Aktuelle Events

Der digitale Produktpass: fünf Erfolgsfaktoren für Unternehmen

Die verpflichtende Vorgabe für digitale Produktpässe (DPPs) lässt nicht mehr lange auf sich warten. Jetzt gilt es, proaktiv eine Datenstrategie zu entwerfen, um die die nahtlose Erfassung, Verwaltung und gemeinsame Nutzung von Daten zu erleichtern.

Erste Marken machen es vor: Ein Jeanshersteller wirbt mit dem Versprechen einer lebenslangen, kostenlosen Reparatur für jede verkaufte Jeans. Hierfür macht das Unternehmen den gesamten Herstellungs-, Transport- und Lagerprozess transparent: Woher stammt der Rohstoff, wer spinnt, webt und färbt den Stoff, woher kommen die Knöpfe und Nieten, wo wird gefertigt und verpackt, und wer liefert und lagert die fertigen Produkte. Ziel ist es, immer die passenden Teile für eine Reparatur zu haben und den Produktionsprozess nach ökologischen und sozialen Gesichtspunkten offen zu legen.

Ein anderer Anbieter experimentiert mit einer kreislauffähigen Modekollektion und hat den digitalen Produktpass in Form eines NFC-Tags in jedes Kleidungsstück eingenäht. Dieser Speicherchip soll alle wichtigen Informationen über Material, Produktion und den richtigen Rückgabekanal enthalten, so dass seine Bestandteile später genau identifiziert werden können.

Ob Lieferkette oder Produkthaftung: Es ist zeitlich absehbar, dass für Hersteller immer mehr Vorschriften über erweiterte Informationspflichten, längere Haftungszeiten und die Reparierbarkeit und Recyclingfähigkeit von Produkten entstehen.

Die Voraussetzung für die Nachverfolgbarkeit all dieser Daten ist ein zentrales Datenmanagementsystem. Dies aufzubauen, kostet Zeit. Firmen sollten jetzt damit anfangen.

Hintergrundinformationen zum DPP

Der digitale Produktpass (DPP) ist eine dieser Gesetzesinitiativen. Er wurde mit der neuen EU-Verordnung über Ökodesign für nachhaltige Produkte (ESPR) eingeführt und dient als Instrument zur Verbesserung der Transparenz und Förderung der Kreislaufwirtschaft. Ihr Ziel besteht darin, Abfälle zu minimieren und die Ressourcen durch Förderung von Nachhaltigkeit und Wiederverwendung optimal zu nutzen. Diese Vorteile entstehen durch den Austausch umfassender Produktinformationen über die gesamte Wertschöpfungskette hinweg. Der DPP fördert die Reparatur und das Recycling von Produkten und zeigt die Umweltauswirkungen während des Lebenszyklus. Ein weiteres Ziel besteht darin, nachhaltige und wiederverwendbare Produkte als Standard auf dem EU-Markt zu etablieren.

Diese neue Methode der digitalen Aufzeichnung und des Austauschs von Produktinformationen in Bezug auf ökologische Nachhaltigkeitsfaktoren erfordert ein Umdenken von international agierenden Unternehmen, die Produkte in der EU verkaufen. Künftig müssen sie digitale Produktpässe in ihren übergreifenden Rahmen für Umwelt, Soziales und Governance (ESG) integrieren.

Dabei sollten sie die folgenden fünf wichtigen Erkenntnisse für einen effektiven Umgang mit den Produktpässen berücksichtigen.

1. Um was es sich beim DPP handelt

Der digitale Produktpass dient als dynamisches digitales Dossier, das den gesamten Lebenszyklus eines Produkts – einschließlich Konzeption, Design, Herstellung und Vertrieb – erfasst und in Form eines „digitalen Zwillings“ zugänglich macht. Er fungiert als digitale Methode zur Aufzeichnung und Weitergabe umfassender Informationen über ein Produkt und seine Bestandteile. Das fördert die Transparenz, Rückverfolgbarkeit und Nachhaltigkeit in der gesamten Lieferkette.

Als Beitrag zur Kreislaufwirtschaft liefern DPPs entscheidende Details über die ökologische Nachhaltigkeit von Produkten. Sie versorgen Interessengruppen wie Regulierungsbehörden und Verbraucher mit Informationen über Reparatur, Recycling, Berichterstattung, Produktnutzung und -auswirkungen. Der digitale Produktpass erfordert eine eindeutige Produktkennung, Firmen können jedoch auch bestehende Technologien wie Barcodes, QR-Codes, RFID-Tags oder etwas Ähnliches verwenden.

Scannt ein Verbraucher beispielsweise einen QR-Code auf dem Etikett eines Smartphones, wird er sofort weitergeleitet und mit dem entsprechenden DPP verbunden. Dieser Pass enthält umfassende Informationen zu den Nachhaltigkeitsmerkmalen des Produkts (Beschaffung, Materialzusammensetzung, Herstellungsverfahren, Reparatur- und Demontagemöglichkeiten sowie Recycling-Richtlinien).

2. Worauf der DPP abzielt

Das DPP soll sowohl Verbrauchern als auch Unternehmen dabei helfen, beim Kauf von Produkten gut informierte Entscheidungen zu treffen. Außerdem soll er die Prozesse im Zusammenhang mit Reparaturen und Recycling rationalisieren und tiefere Einblicke in die Umweltauswirkungen während des gesamten Lebenszyklus eines Produkts ermöglichen.

Darüber hinaus soll der Produktpass die Behörden bei der Durchführung wirksamerer Prüfungen und Kontrollen unterstützen, indem er zuverlässige Informationen in Echtzeit liefert.

3. Wer sich für den DPP interessieren sollte

Für Unternehmen, die beispielsweise Textilien, Elektronik, Bauprodukte oder Batterien herstellen und diese in der EU verkaufen, spielt der DPP eine wichtige Rolle. Die für die ESPR vorgeschlagenen Regeln gelten für alle Produkte in der EU – unabhängig davon, wo sie hergestellt werden. Lediglich für einige wenige Branchen (etwa Lebensmittel, Futtermittel oder medizinische Produkte) gelten andere Vorschriften.

Der DPP soll für etwa 30 Kategorien gelten und voraussichtlich ab 2026 eingeführt werden, der Starttermin hängt von der endgültigen Genehmigung ab. Als erste betroffene Produktkategorie kommen dann Batterien an die Reihe, kurz danach werden auch Bekleidung und Unterhaltungselektronik den Vorschriften entsprechen müssen.

4. Was der DPP für Unternehmen bedeutet

Die Umsetzung des Produktpasses erfordert die Erfassung, Verwaltung und Weitergabe relevanter Informationen wie Produktdaten und Lieferkettendetails. Im Rahmen des DPP wurden verschiedene Anforderungen festgelegt, darunter Haltbarkeit, Wiederverwendbarkeit, Aufrüstbarkeit und Reparierbarkeit. Auch Stoffe, die sich auf die Kreislaufwirtschaft auswirken, spielen eine Rolle, ebenso wie Energie- und Ressourceneffizienz, Recycling und der Umweltfußabdruck. Die Art der erfassten Informationen hängt vom Produkt ab. So enthält der DPP für Unterhaltungselektronik ausführliche Informationen über Materialien, Reparaturen und Recyclingdaten, während der DPP für Verpackungen den Prozentsatz an recyceltem Material hervorhebt, aber keine Reparaturinformationen beinhaltet.

Zu den Hauptbestandteilen eines DPP zählt die Produktidentität und -historie: Eindeutige Identifikatoren ermöglichen es den Beteiligten, das Produkt bis zu seinem Ursprung zurückzuverfolgen. Diese Funktion hilft bei der Bekämpfung von Produktfälschungen. Auch die Transparenz der Lieferkette gilt als wichtiger Baustein: Die Echtzeitverfolgung dokumentiert die Reise durch die gesamte Lieferkette.

Diese Transparenz ermöglicht es, Ineffizienzen zu erkennen, Risiken zu verringern und die Einhaltung ethischer und ökologischer Standards zu gewährleisten. Last, but not least erfasst ein DPP auch noch den gesamten Lebenszyklus eines Produkts. Diese Fülle an Informationen ermöglicht es den Verantwortlichen, fundierte Entscheidungen zu treffen, Prozesse zu optimieren und die Produktqualität insgesamt zu verbessern.

5. Die Rolle von Stammdaten im DPP-Ökosystem

Hersteller und Zulieferer geben Produktdaten auf unterschiedliche Weise für DPPs frei. Viele Unternehmen, die digitale Produktpässe einführen wollen, stehen jedoch vor der Herausforderung, dass sie keinen Einblick in ihre Lieferketten haben. Für bessere Einblicke und mehr Rentabilität ist es für alle Organisationen in der Lieferkette unerlässlich, zusammenzuarbeiten und die erforderlichen Informationen effizient auszutauschen.

Hierbei kommt der Verwaltung von Stammdaten eine Schlüsselrolle zu, da die für die Nachhaltigkeit eines Produkts relevanten Informationen oft über verschiedene Geschäftssysteme verstreut sind. Um einen verlässlichen DPP-Rahmen zu schaffen, müssen der Chief Data Officer (CDO) und der Chief Sustainability Officer (CSO) in einem Unternehmen diese Daten an einem zentralen Speicherort sammeln und die Governance durch Deduplizierung, Datenqualitätskontrolle und Workflow-Automatisierung sicherstellen.

Um einen effektiven DPP zu erstellen, ist es wichtig, den Lebenszyklus eines Produkts vollständig zu verstehen. Firmen müssen dazu in der Lage sein, Informationen über die gesamte Lieferkette hinweg problemlos zu verfolgen. Dazu benötigen sie Systeme, die verschiedene Arten von Daten erfassen und organisieren können, etwa Nachhaltigkeitsdetails, Firmenstandort und Materialzusammensetzung.

Diese Systeme müssen auch mit den Änderungen der DPP-Standards Schritt halten. Um die Vorschriften einzuhalten, müssen Betriebe wichtige Daten sammeln und sie sicher an die richtigen Personen in der Lieferkette weitergeben. Der Schwerpunkt sollte dabei auf Initiativen zur Produktverbesserung und zur Minimierung der Umweltauswirkungen liegen.

Ein Produkt-Informationsmanagement-System (PIM) mit eingebetteter Datenverwaltung kann als Eckpfeiler im DPP-Ökosystem dienen. Es gewährleistet die Zuverlässigkeit standardisierter Informationen, denn nur diese ermöglichen es Unternehmen, ihren Kunden und Geschäftspartnern Details und tiefgehende Einblicke in Produktmaterialien zu vermitteln.

PIM-Systeme spielen auch eine entscheidende Rolle bei der nahtlosen Integration von DPPs in verschiedene Systeme innerhalb einer Lieferkette, indem sie die Interoperabilität mit den Enterprise Resource Planning, Product Lifecycle Management, Master Data Management (MDM) und anderen Plattformen verbessern. Dank dieser Flexibilität gelingt es Firmen, sich an veränderte Eigenschaften, Vorschriften und Marktanforderungen anzupassen und so Skalierbarkeit und Agilität zu gewährleisten.

Trotz der Fähigkeiten eines PIM-Systems unterstreichen die zahlreichen Datendomänen die Notwendigkeit einer Plattform, die Beziehungen und komplizierte Hierarchien verwalten kann. Eine Standard-PIM-Lösung deckt möglicherweise nicht alle DPP-Anforderungen ab, wenn es beispielsweise um die Speicherung von Lieferanteninformationen neben Produktdaten, Standorten und Materialinformationen geht. Es empfiehlt sich, den Ansatz mit einer Multidomain-MDM-Lösung zu kombinieren, die präzise Daten über alle Bereiche hinweg bereitstellt. Dies versetzt CDOs und CSOs in die Lage, alle Datenbeziehungen und komplexen Hierarchien zu verwalten, die für DPPs unerlässlich sind.

Was kommt als Nächstes?

Die Einbindung von DPPs in den primären ESG-Rahmen eines Unternehmens zählt mittlerweile zum Pflichtprogramm, da die verpflichtende Vorgabe für DPPs nicht mehr lange auf sich warten lässt. Jetzt ist der richtige Zeitpunkt für Unternehmen, um proaktiv eine umfassende Datenstrategie zu entwerfen und Lösungen zu finden, die die nahtlose Erfassung, Verwaltung und gemeinsame Nutzung von Daten erleichtern. Dieser proaktive Ansatz ermöglicht es Firmen, den Entwicklungen der Vorschriften einen Schritt voraus sein.

Der Autor Levent Ergin ist Global Chief ESG Sustainability Strategist beim Datenmanagement-Spezialisten Informatica und arbeitet mit führenden Organisationen zusammen, ihre ESG-Berichterstattung zu beschleunigen und Nachhaltigkeitsentscheidungen zu unterstützen.

Diese Artikel könnten Sie auch interessieren:

Tatendrang trifft Struktur – Ist Deutschland wirklich innovationsmüde?

Gründer*innen haben Gestaltungswillen, aber Bürokratie wirkt als tödliche Handbremse. Im Experten-Interview verrät Zukunftsberater und Start-up-Mentor Dr. Jenkis, was sich jetzt ändern muss.

In der öffentlichen Debatte wird Deutschland oft als Land der Bedenkenträger*innen und der bürokratischen Starre gezeichnet. Doch während die Medien über eine allgemeine Verunsicherung berichten, zeigt ein Blick in die Werkstätten und Büros von Gründer*innen und Unternehmer*innen ein anderes Bild: Hier herrscht „Gestaltungslust“ statt Stillstand.

Eine aktuelle Umfrage der ZUKUNFTSWERKE GmbH mit dem Titel „TATENDRANG TRIFFT STRUKTUR: Innovation im Spannungsfeld zwischen Willen und Wirklichkeit“ räumt mit gängigen Klischees auf. Die Ergebnisse belegen, dass der unternehmerische Kern längst auf Aufbruch programmiert ist: 32 Prozent der Befragten treibt der Wille an, die Zukunft aktiv zu gestalten.

Dr. Dirk Jenkis ist Zukunftsberater und Start-up-Mentor sowie der Kopf hinter ZUKUNFTSWERKE und Experte für die Dynamiken zwischen unternehmerischem Willen und strukturellen Rahmenbedingungen. Warum Innovationen oft auf halber Strecke stecken bleiben und warum das Problem weniger in den Köpfen als in den Strukturen liegt, erklärt er im Interview.

Herr Dr. Jenkis, Ihre Studie zeigt: 32 % der Unternehmer*innen wollen Zukunft aktiv gestalten, statt sie nur zu verwalten. Warum klafft die Schere zwischen diesem inneren Tatendrang und der öffentlichen Wahrnehmung einer „lahmenden Wirtschaft“ so weit auseinander?

Dr. Jenkis: Weil wir zwei völlig unterschiedliche Bilder betrachten. Innen sehe ich Unternehmer mit Energie, Ideen und einem klaren Gestaltungswillen. Außen diskutieren wir oft über Symptome: schwaches Wachstum, zähe Prozesse, Unsicherheit. Das Problem ist nicht fehlender Tatendrang. Das Problem ist, dass dieser Tatendrang in einem Umfeld stattfindet, das ihn oftmals ausbremst. Wenn Sie ständig gegen Bürokratie, langsame Verfahren oder unklare Regeln anlaufen, wirkt selbst die dynamischste Organisation irgendwann träge. Die Wirtschaft ist also nicht lahm. Sie läuft nur oft mit angezogener Handbremse.

Mut (27 %) und Neugier (23 %) sind laut Umfrage die wichtigsten Zutaten für Innovation. Warum ist das „Entscheiden ohne vollständige Datenbasis“ heute die wichtigste Kernkompetenz für Gründende?

Dr. Jenkis: Weil die Welt schneller ist als jede Datengrundlage. Wer wartet, bis alles sicher ist, kommt schlicht zu spät. Gründer bewegen sich immer im Ungewissen. Genau dort entsteht Innovation. Mut heißt nicht Leichtsinn, sondern beschreibt die Fähigkeit, mit Unsicherheit produktiv umzugehen.

Und Neugier sorgt dafür, dass man die richtigen Fragen stellt, statt nur auf Antworten zu warten. Die Kombination aus beidem ist entscheidend: neugierig denken, mutig handeln. Wer das beherrscht, hat einen echten Wettbewerbsvorteil.

Ihre Studie weist darauf hin, dass die gefürchtete Risikoaversion oft bei Kapitalgeber*innen und Investor*innen sitzt. Wie pitcht man als Start-up erfolgreich gegen ein Umfeld an, das zwar Innovation fordert, aber offensichtlich Angst vor dem Scheitern hat?

Dr. Jenkis: Indem man Klarheit schafft. Investoren reagieren nicht auf Vision allein, sondern auf nachvollziehbare Logik. Ein guter Pitch verbindet Mut mit Struktur. Er zeigt: Ich weiß, was ich tue, auch wenn ich nicht alles weiß. Gleichzeitig braucht es auf der Investorenseite mehr Bereitschaft, Risiko als Teil von Innovation zu akzeptieren. Kapitel entscheidet mit darüber, wie viel Innovation möglich wird. Wer nur sichere Wetten eingeht, bekommt keine Durchbrüche.

Die größte Bremse ist nicht der mangelnde Wille, sondern fehlende Ressourcen und regulatorische Hürden. Ist der „Innovationsstandort Deutschland“ also eher ein Sanierungsfall der Strukturen als ein Problem der Köpfe?

Dr. Jenkis: Es ist ganz klar ein Strukturthema. Ich habe in den Antworten dieser Studie sehr viel Energie gesehen. Sehr viel Bereitschaft, Verantwortung zu übernehmen und Neues zu schaffen. Was fehlt, sind oft Geschwindigkeit, Verlässlichkeit und Einfachheit im System. Das Gute daran ist aber: Strukturen lassen sich verändern, wesentlich leichter als Mindset. Und genau darin liegt die Chance. Wir müssen nicht erst Motivation erzeugen. Wir müssen die vorhandene Motivation freisetzen und Gründern mehr Steine aus dem Weg räumen.

15 % der Befragten klagen über zu viele Prozesse und zu wenig Freiheitsgrade. Wie bewahren sich Start-ups beim Wachsen ihre Agilität, ohne in die „Konzern-Falle“ zu tappen?

Dr. Jenkis: Die „Konzern-Falle“ entsteht, wenn Prozesse zum Selbstzweck werden. Wachstum braucht Struktur, aber Struktur muss Klarheit schaffen, statt Tempo zu nehmen. Viele Scale-Ups bauen sich schleichend Komplexität auf, die sie später selbst ausbremst. Entscheidend ist, dass Gründer sich mitentwickeln und ihr eigenes System immer wieder hinterfragen. Ohne Widerspruch entsteht schnell eine Echokammer. Agilität bleibt, wenn jemand regelmäßig stört, Fragen stellt und Entscheidungen schärft. Am Ende gilt: Nicht weniger Prozesse machen agil, sondern die richtigen.

77 % der Befragten haben ihr Geschäftsmodell im letzten Jahr grundlegend hinterfragt. Ist eine permanente „positive Paranoia“ heute die einzige Überlebensstrategie?

Dr. Jenkis: Schon 1996 schrieb der Intel-Mitgründer Andy Groove sein Buch mit dem Titel „Only the Paranoid survive“. Ich würde es eher Wachsamkeit nennen. Erfolgreiche Gründer entwickeln schnell ein feines Gespür dafür, wann sich etwas verändert. Sie hinterfragen sich regelmäßig, ohne sich ständig neu zu erfinden. Das ist ein kontinuierlicher Lernmodus. Wer bestehen will, braucht die Fähigkeit, Stabilität und Bewegung gleichzeitig zu organisieren. Das war schon immer so, ist in der schnelllebigen Wirtschaftswelt von heute aber noch wichtiger.

21 % nutzen bewusst externe Impulse und Netzwerke, um Stillstand zu überwinden. Warum ist das „Schmoren im eigenen Saft“ für junge Unternehmen gefährlicher als jede(r) Wettbewerber*in?

Dr. Jenkis: Weil es die Wahrnehmung verengt. Wenn man nur mit Menschen spricht, die ähnlich denken, entstehen schnell Echokammern. Ideen klingen in der eigenen Blase immer besser, als sie wirklich sind. Risiken werden ausgeblendet, blinde Flecken übersehen. Externe Impulse dagegen bringen Reibung. Und genau diese Reibung sorgt für Klarheit. Wer mit offenen Augen und Ohren durch die Welt geht, sich für Neues begeistert und sich bewusst von anderen – etwa Mentoren oder Sparringspartnern – hinterfragen lässt, entwickelt sich weiter. Wettbewerb fordert von außen. Selbstüberschätzung entsteht von innen.

Im „Museum des Scheiterns“ Ihrer Befragten hängen eher leise Fehlentscheidungen wie unpassende Teams oder kulturelle Blockaden. Was ist die wichtigste Lektion, die Gründende aus diesen strukturellen Fehlern ziehen können?

Dr. Jenkis: Erfolg entscheidet sich selten an der Idee. Vielmehr sind es die Menschen und ihre Art, wie sie zusammenarbeiten. Denn die meisten Probleme entstehen nicht spektakulär, sondern schleichend. Falsche Besetzungen, unklare Kommunikation, fehlendes Vertrauen. Die wichtigste Lektion ist deshalb: Organisation und Kultur sind keine Nebenthemen. Sie sind der Kern unternehmerischen Erfolgs. Darum hier nochmal die klassischen Zitate von Peter Drucker und Safi Bahcall: „Culture eats strategy for breakfast. Structure eats culture for lunch.“

Zum Abschluss: Sie ziehen in Ihrer Studie einen Vergleich zur historischen Fernfahrt von Bertha Benz und sagen: Die Ideen stehen bereit, aber der Weg muss frei werden. Wenn wir dieses Bild auf heute übertragen: Welche eine strukturelle Weiche muss die Politik jetzt stellen, damit die nächste große Idee in Deutschland endlich freie Fahrt bekommt?“

Dr. Jenkis: Verlässlichkeit. Unternehmer können mit Unsicherheit umgehen. Was sie brauchen, sind klare, stabile Rahmenbedingungen. Wenn Regeln nachvollziehbar sind und auf Freiheiten bieten, Verfahren schnell laufen und Entscheidungen planbar werden, entsteht automatisch mehr Bewegung. Die Ideen stehen bereit. Die Menschen auch. Jetzt geht es darum, die Straße so zu gestalten, dass sie frei bleibt.

Dr. Jenkis, Danke für die spannenden Insights!

Das Interview führte StartingUp-Chefredakteur Hans Luthardt

Retourendaten als ungenutztes Potenzial

Retouren sind dein größter Kostenfaktor – aber auch eine wertvolle Datenquelle. Unser Artikel samt Praxis-Checkliste zeigt dir, wie du sie strategisch zum Marketing-Booster machst!

Retouren kosten den Handel jedes Jahr Millionen Euro. Dabei wird oft verkannt, dass sie auch eine wertvolle Quelle für mehr Umsatz und eine bessere Customer Journey sind. Aktuelle Daten aus dem Jahr 2025 zeigen, wie sich das Retourenverhalten von Verbrauchern entwickelt – und welche ungenutzten Chancen hierbei für dich und dein E-Commerce-Unternehmen liegen.

Die wichtigste Erkenntnis aus dem aktuellen Retouren-Report 2025: Immer weniger Kunden senden ihre Einkäufe zurück. Im Jahr 2025 waren es nur noch 46 Prozent – im Vergleich zu 51 Prozent in 2024 und 67 Prozent im gleichen Zeitraum 2023.

Trotz dieser sinkenden individuellen Retourenneigung prognostiziert die Universität Bamberg für Deutschland im Jahr 2025 ein neues Rekordvolumen von 550 Millionen Paketen. Um dieser Diskrepanz zu begegnen, musst du als Online-Händler deine Zielgruppen basierend auf den bei der Retoure gewonnenen Einsichten künftig präziser ansprechen.

Wenn Daten ungenutzt verpuffen

Noch immer ignorieren viele Online-Shops, wer welche Produkte warum zurückschickt. Betrachtest auch du Retouren oft ausschließlich aus der reinen Umsatzperspektive und übersiehst die damit verbundenen wertvollen Details zu Zielgruppen, Produkten und Kanälen? Viele erfassen zwar Retourengründe, doch nur ein Bruchteil wertet diese systematisch und automatisiert aus. Dabei könntest du genau diese Daten nutzen, um ein tiefgreifendes Verständnis für das Kauf- und Retourenverhalten deiner Kunden zu gewinnen.

Ohne diese Analyse gehst du das Risiko ein, dass beispielsweise Produkte mit einer hohen Retourenquote weiterhin bei Zielgruppen beworben werden, die sie überdurchschnittlich oft zurücksenden. Nutze deine Tools konsequent und schließe Kundengruppen, die deine Marge gefährden, vom Targeting aus. Bei durchschnittlichen Bearbeitungskosten von 5 bis 20 Euro pro Retoure – im komplexen Sortiment sogar bis zu 50 Euro – entstehen dir sonst erhebliche, aber vermeidbare Verluste.

Ein weiteres Beispiel für verpasste Chancen zeigt ein Blick auf die Rückgabepräferenzen. Demnach wünschen sich Frauen deutlich häufiger alternative Rückgabeoptionen als Männer (63 Prozent versus 53 Prozent). Ein klarer Hinweis darauf, dass Standardangebote hier weniger gut ankommen. Dennoch sprichst du in der Praxis vermutlich beide Zielgruppen identisch an.

Retourendaten als Marketing-Kompass

Die Lösung hast du paradoxerweise wahrscheinlich bereits im Haus: deine Retourendaten. Durch eine systematische und strategische Auswertung lassen sie sich als wertvolle Marketing-Intelligence nutzen. Ein zentraler Baustein sind datenbasierte Analysen, die Kaufhistorie, Kontaktpunkte, Retourenmuster sowie bevorzugte Produktkategorien verknüpfen.

Eine gezielte Steuerung der Kundenansprache und der Produktpositionierung nimmt unmittelbar Einfluss auf das Retourenverhalten. So wird es dir möglich, Produkte mit hoher Retourenquote für bestimmte Zielgruppen aus dem Fokus zu nehmen. Wird beispielsweise ein bestimmtes Schuhmodell bei den über 45-Jährigen überdurchschnittlich oft retourniert, solltest du es für diese Altersgruppe nicht mehr in Marketingkampagnen ausspielen.

Ebenso wie dein Produktportfolio kannst du auch deine Services an klare Kundenwünsche anpassen: 58 Prozent der Kunden wünschen sich neben der klassischen „Retoure gegen Erstattung“ auch andere Optionen wie Umtausch, Gutscheine oder Reparaturen. Diese Erkenntnis ermöglicht dir differenzierte, zielgruppengerechte Serviceangebote und schützt dich vor einem kompletten Umsatzverlust.

Auch eine datenbasierte Kanalbewertung wird möglich: Während 33 Prozent der 18- bis 34-Jährigen Social Commerce als Einkaufskanal nutzen, sind es bei den über 55-Jährigen nur rund 15 Prozent. Retourendaten zeigen dir präzise, welche Kanäle für bestimmte Produkte problematisch sind und wo du Budgets umschichten musst.

Erst eine konsequente Analyse der Retourengründe macht es dir möglich, Produktinformationen zu optimieren und Vertriebskanäle belastbar zu bewerten. Statt Millionen für Streuverluste auszugeben, kannst du deine Customer Journey gezielt verbessern.

Silos ade: Zusammenarbeit von Marketing, E-Commerce und Produktteams

Entscheidend für die optimale Nutzung dieser Einsichten ist der regelmäßige Austausch zwischen deinen Marketing-, E-Commerce- und Produktteams. Im Zusammenspiel können Erkenntnisse aus Retourengründen nahtlos in Produktbeschreibungen und Kampagnenbotschaften einfließen.

Wenn dein E-Commerce-Team beispielsweise feststellt, dass bestimmte Farbvarianten bei spezifischen Altersgruppen besonders oft mit dem Grund „sieht anders aus als erwartet“ retourniert werden, können Marketing und Produktentwicklung sofort reagieren: durch bessere Produktfotos, angepasste Beschreibungen und eine differenzierte Zielgruppenansprache.

Diese abteilungsübergreifende Verschränkung erfordert jedoch neue Prozesse: Wöchentliche Retourendaten-Reviews, gemeinsame KPIs und automatisierte Alerts bei auffälligen Retourenmustern sind Pflicht. Nur so wird aus der reaktiven Kostenstelle ein proaktives Steuerungsinstrument.

Daten bringen nachhaltigen Erfolg

Wenn du Retourendaten strategisch nutzt, sparst du nicht nur Kosten. Du steigerst die Konversion, senkst Streuverluste und reduzierst den Kundenfrust. Echter Erfolg stellt sich schließlich erst dann ein, wenn der Kunde sich nicht nur für den Kauf entscheidet, sondern das Produkt am Ende auch behält.

Begreife Retouren daher noch stärker als präzise Datenquelle für eine bessere Kundenbeziehung. Wenn du deine Retourendatenanalyse jetzt professionalisierst, verwandelst du den Kostenfaktor endgültig in deinen Marketing-Booster.

Der Autor Artjom Bruch ist CEO der Trusted Returns GmbH

StartingUp-Checkliste: So machst du deine Retourendaten zum Marketing-Booster

Prüfe dein aktuelles E-Commerce-Setup. Wie viele dieser Fragen kannst du bereits mit „Ja“ beantworten?

- [ ] Präzise Datenerfassung: Erfasst du detaillierte Retourengründe (über ein Dropdown-Menü im Retourenportal) statt nur eines pauschalen „Gefällt nicht“?

- [ ] Dynamisches Targeting: Schließt du Kunden oder Segmente, die ein bestimmtes Produkt überdurchschnittlich oft retournieren, automatisch von der weiteren Bewerbung dieses Artikels aus?

- [ ] Zielgruppengerechte Rückgabe-Optionen: Bietest du im Retourenprozess aktiv Alternativen wie Direkt-Umtausch, Store-Credit (Gutschein) oder Reparatur an, anstatt sofort den Kaufpreis zu erstatten?

- [ ] Kanal-Rentabilitäts-Check: Analysierst du, ob Kunden, die über Plattformen wie TikTok oder Instagram kaufen, eine signifikant höhere Retourenquote aufweisen als Käufer aus dem E-Mail-Marketing?

- [ ] Silos aufbrechen: Gibt es ein regelmäßiges (z. B. wöchentliches) Meeting zwischen Marketing, E-Commerce und Produktmanagement, um auffällige Retourenmuster zu besprechen?

- [ ] Automatisierte Warnsysteme: Erhält dein Team einen automatischen Alert, wenn die Retourenquote eines neu gelaunchten Produkts innerhalb der ersten 48 Stunden einen definierten Schwellenwert übersteigt?

Je mehr Haken du setzen kannst, desto näher bist du am profitablen Retouren-Management.

Fokussieren statt Feuerlöschen

Mit den richtigen Hilfsmitteln zu mehr Klarheit im Gründungsalltag – so geht’s.

Gründer*innen bewegen sich häufig in einem Dreieck des Mangels. Geld, Zeit oder schlichtweg Manpower: Irgendetwas fehlt immer. Vielleicht hast du gerade eine Finanzierungsrunde abgeschlossen und willst Mitarbeitende einstellen, Prototypen fertigstellen oder Tools einkaufen – und das am liebsten gleichzeitig. Der finanzielle Spielraum verschafft einen Moment des Durchschnaufens, der schon bald von Zeitknappheit abgelöst wird. Es soll schließlich mit dem Kapital schnell etwas auf die Beine gestellt werden, das einen gewissen ROI bringt. Oder du hast all das umgesetzt, das Team steht, erste Schritte sind gemacht. Doch das vorhandene Kapital schmilzt schneller als gedacht und der Druck verschiebt sich wieder auf die Finanzen.

Was du tun kannst, damit neben dem Feuerlöschen Zeit für Strategiearbeit und Marketing bleibt, erfährst du hier.

Zwischen Idealvorstellung und Realität

Es klingt einfach: Produkt entwickeln, Markt und Zielgruppe analysieren, Strategie ableiten, und los geht’s. Schön wär’s. In der Realität läuft im Gründungsprozess alles gleichzeitig. Entwicklung, Teamaufbau, erste Kund*innen, operative Themen und mittendrin persönliche Vorlieben. Manche Gründer*innen sind stark in der Produktentwicklung, andere im Vertrieb oder Investor*innengespräch, wieder andere gestalten leidenschaftlich gern ihre Marke. Doch wenn es sich nicht gerade um ein eingespieltes Team mit klarer Stärkenverteilung handelt, lasten alle Aufgaben auf einer Person. Neben den unterschiedlichen Themenfeldern kommt noch hinzu, dass jede Phase im Gründungsprozess neue Herausforderungen mit sich bringt.

Zu Beginn bleiben einem/einer gründenden Angestellten oder Student*in nur Feierabend und Wochenende, um an der Idee zu arbeiten. Und das häufig allein.

Später kommt Kapital ins Spiel und Investor*innen steigen ein. Damit ergeben sich mehr Möglichkeiten in der Produktentwicklung, aber auch im Aufsetzen von Systemen zur Automatisierung.

Das schafft wiederum Klarheit und Zeit, um erste Mitarbeiter*innen einzustellen, die Aufgaben übernehmen und damit etwas Luft verschaffen. Doch mit den steigenden Ausgaben werden die finanziellen Mittel wieder knapper. Oder es wird eine Agentur beauftragt, die ein Top-Marketingkonzept erstellt, welches schlimmstenfalls wochenlang in der Schublade wartet, weil durch einen plötzlichen Anstieg an Aufträgen keine Zeit mehr bleibt, es umzusetzen.

Wo bleibt da die Strategiearbeit?

Inmitten aller Feuer, die gelöscht werden wollen, stellt sich die Frage: Wie soll man die mentale Freiheit für strategische Arbeit behalten? Dabei geht es vor allem um Positionierung, Story, Vision und Mission. Diese Grundlagen dienen nicht nur als Fundament für das Marketing, sondern auch als Nordstern für Entscheidungen und Aktivitäten des gesamten Teams.

Auf die Relevanz dieser strategischen Basis wurde im einleitenden Online-Beitrag „Entrepreneurial Marketing“ bereits hingewiesen (nachzulesen unter t1p.de/n7dv5) und darin empfohlen, sich ein festes Zeitfenster pro Woche für die Strategiearbeit zu blocken. Wer das schafft, ist schon ziemlich weit. Denn es braucht zwar Zeit, spart langfristig aber enorm viele Ressourcen und sorgt für Klarheit im Handeln.

Kann das nicht einfach KI übernehmen?

Neben der Herausforderung, die anfallenden Aufgaben zu managen, stehen Gründer*innen zusätzlich vor einer Flut an Optionen: Informationen, Lernangebote und Quellen für Ideen prasseln über Social Media, Newsletter oder Podcasts auf uns alle ein. Man hat Zugang zu einer Fülle von Tools, um Ideen zu generieren, die in eine stimmige Marke mit konsistenter Sprache und durchdachter Strategie einfließen sollen. Dazu kommt ein bunter Strauß an Tools, den ein Unternehmen vermeintlich „von allein“ aufbauen kann und der auf Knopfdruck Texte, Bildwelten, Produktnamen oder Content-Pläne liefert. Eine berechtigte Frage drängt sich auf: Ist es in Zeiten künstlicher Intelligenz (KI), die Assistenten für fast alles bietet, wirklich nötig, sich noch selbst hinzusetzen?

FOMO und Tool-Fatigue

KI ist ein wunderbares Hilfsmittel, um Gedanken zu strukturieren, einen kreativen Schubs zu erhalten oder Arbeitsschritte zu automatisieren. Sich allerdings ausschließlich darauf zu verlassen, ist trügerisch. Es gibt mittlerweile eine fast unüberschaubare Zahl an Anwendungen für sämtliche Aufgaben, und viele der Tools sind kostenlos verfügbar. Das verführt dazu, sich bei möglichst vielen anzumelden und herumzuprobieren. Was folgt, ist selten effektiv. Statt Klarheit entsteht ein Gefühl des Zuviel. Zu viele Tools, zu viele unterschiedliche Features, zu viel hin und her springen zwischen den Anwendungen. Dazu kommt FOMO, die Angst, etwas zu verpassen. Was, wenn genau dieses Tool das Start-up skalieren könnte? Oder jenes die perfekte Markenidentität liefert?

Dieses „noch kurz Ausprobieren“ kostet Zeit und bringt selten substanziellen Fortschritt. Im Gegenteil, kann es sogar zur sogenannten Tool-Fatigue führen. Das Management bzw. der ständige Wechsel zwischen verschiedenen User Interfaces und die Fragmentierung der Informationen führen zu Überforderung. Neben dem Überblick verliert man so die Klarheit, welches Werkzeug welchem Nutzen dient und das Unternehmen seinem eigentlichen Ziel näherbringt.

Was also tun?

1. Systeme schlank halten

Wenn das Gefühl aufkommt, sich in der Fülle an Plattformen und Möglichkeiten zu verlieren, hilft es, einen Schritt zurückzutreten und sich auf das Ziel zu besinnen. Was ist aktuell der wichtigste Schritt? Soll die Story geschärft werden? Müssen Investor*innen oder Kund*innen angesprochen werden? Geht es darum, die eigene Präsenz weiter auszubauen? Je nachdem, wo das Unternehmen steht, kannst du die sinnvollsten Aktivitäten ableiten und gezielt Tools auswählen.

Mindestens genauso wichtig ist es, regelmäßig die Abos zu prüfen. Welche Tools wurden in den letzten drei Monaten nicht genutzt und sind diese wirklich noch relevant? Lautet die Antwort nein, kann man sie getrost kündigen. So bleiben das Set-up und der Passwort-Safe schlank.

2. Die passenden Tools wählen

Wähle deine Systeme von Anfang an mit Weitblick. Gerade zu Beginn neigen Gründer*innen dazu, sich auf akuten Bedarf und möglichst geringe Kosten zu konzentrieren. Für langfristigen Erfolg empfiehlt sich aber, sowohl die nächsten Entwicklungsstufen deines Unternehmens als auch des Systems mitzudenken. Ein mitwachsendes System macht sich langfristig bezahlt. Ein späterer Wechsel kostet hingegen nicht nur Geld, sondern auch Zeit, insbesondere wenn Schnittstellen betroffen sind oder Daten migriert werden müssen.

3. Die richtigen Dinge tunAuch bei KI kommt es auf den richtigen Einsatz an. Gute Ergebnisse beginnen mit einem guten Prompt. Dafür gibt es inzwischen unzählige Kurse und Vorlagen. Je klarer und durchdachter der Prompt, desto besser das Ergebnis. Aber: Ein guter Prompt allein reicht nicht. Selbst das schönste Ergebnis erfordert eingehende Prüfung. Denn KI erschafft nichts wirklich Neues, sondern greift auf Bestehendes zurück. Hinzu kommt, dass Suchmaschinen rein KI-generierte Inhalte erkennen. Von Menschen angepasste, individualisierte Inhalte performen meist besser. Verlass dich außerdem nicht blind auf Fakten und Quellen. Viele KIs halluzinieren und neigen zur Übertreibung. Ein Faktencheck und die Prüfung der Quellen gehören unbedingt in den Workflow.

Warum internationale Unternehmen Österreich als F&E-Standort wählen

Weshalb internationale Unternehmen ihre F&E-Aktivitäten in Österreich ausbauen, welche Rolle Kooperationen mit Forschungseinrichtungen und Start-ups spielen und wie die Austrian Business Agency (ABA) dabei unterstützt, erzählen Martin Gruber (NXP Semiconductors), Stefan Poledna (TTTech Auto) und Gerald Seifriedsberger (GE HealthCare Austria) im Interview.

Österreich zählt zu den innovationsstärksten Ländern Europas und gehört im European Innovation Scoreboard zur Gruppe der „Strong Innovators“. „Maßgeblich zu unserer Position tragen internationale Unternehmen bei, die Österreich gezielt als Standort für Forschung und Entwicklung (F&E) nutzen und zahlreiche Innovationen hervorbringen. Die österreichischen Niederlassungen internationaler Konzerne leisten einen maßgeblichen Beitrag für den Innovationsstandort Österreich – sie sind mit 2,6 Milliarden Euro für mehr als die Hälfte der unternehmensfinanzierten F&E-Ausgaben verantwortlich”, so Marion Biber, Head of INVEST in AUSTRIA bei der Standortagentur ABA.

Österreich ist in den letzten Jahrzehnten generell viel innovativer geworden: Zwischen 2000 und 2023 wuchsen die F&E-Ausgaben hierzulande um 73 Prozent – deutlich stärker als im EU-Durchschnitt mit 24 Prozent.

Forschung und Entwicklung

Forschung und Entwicklung sind zentrale Treiber für wissenschaftlichen und technologischen Fortschritt. Österreich bietet für beide Bereiche optimale Rahmenbedingungen – nicht zuletzt durch ein europaweit einzigartiges Fördermodell, das direkte (durch die FFG) und indirekte Forschungsförderung (durch die Forschungsprämie) kombiniert.

Internationale Unternehmen treffen hier außerdem auf eine dichte Forschungslandschaft, und ein Ökosystem, in dem Zusammenarbeit mit Forschungseinrichtungen und Start-ups nicht Ausnahme, sondern Alltag ist.

Steirischer Ort mit globaler Wirkung

Viele der Unternehmen, die in Österreich forschen und entwickeln, agieren im B2B-Bereich und bleiben daher für Endkonsument*innen oft unsichtbar. Einer dieser Player ist NXP Semiconductors, ein niederländischer Halbleiterkonzern mit rund 35.000 Mitarbeitenden in über 30 Ländern. Einer der wichtigsten F&E-Standorte befindet sich im steirischen Gratkorn.

Dort arbeiten heute rund 650 Expert*vinnen aus 45 Nationen an Zukunftsthemen wie Edge AI, Cybersecurity und Post Quantum Cryptography. “Der Standort Österreich ist ganz essentiell für uns und für die Entwicklung von innovativen, neuartigen Halbleiterprodukten. NXP Österreich ist für uns als internationalen Konzern ein sehr wichtiger Forschungs- und Entwicklungsstandort”, so Martin Gruber, Vice President Corporate Strategy bei NXP Semiconductors. Besonders stark vertreten ist NXP im Mobility- und Automotive-Bereich, aber auch in Industrial- und IoT-Anwendungen.

5 Erfolgsfaktoren für (bootstrappende) Start-ups

Kapital bleibt schwer zugänglich: Was Gründer*innen jetzt von bootstrappenden Start-ups lernen können.

Andreas Lehr, Bootstrapper, Gründer und Host des Podcasts Happy Bootstrapping, hat mit über 150 bootstrappenden Gründer*innen gesprochen und aus den Gesprächen fünf Erfolgsfaktoren herausgearbeitet. Darunter Ansätze, die jetzt im aktuellen Funding-Klima von großer Bedeutung sind.

- Extreme Kund*innenfokussierung statt starker Wachstumsfokus.

- Profitables Wachstum mit kleinen Teams, Gründen in Teilzeit.

- Nischen-Strategien, die die Skalierung in einen breiteren Markt ermöglichen.

- Community-getriebene Produktentwicklung / Building in Public.

Lehrs Erkenntnis: „Bootstrapping gewinnt in der deutschen Start-up-Landschaft sichtbar an Gewicht. Immer mehr Gründer*innen setzen auf unabhängiges Wachstum. Genau die Strategien, die Bootstrapper*innen erfolgreich machen, werden für Gründer*innen in einem vorsichtigeren Markt zu wichtigen Werkzeugen, um Unternehmen stabil aufzubauen.“

5 Erfolgsfaktoren für (bootstrappende) Start-ups

1. Build in community, not just in public

- Eine Community ist eine dauerhafte Feedback-Quelle für bestehende und kommende Produkte.

- Aufbau enger Nutzer*innengruppen auf Discord, Instagram und per On-Site-Events sorgt für loyale Unterstützung.

- Eine Community liefert Ideen für neue Features und Produkte und hilft dabei sie zu validieren.

- Enge Interaktion sorgt für Loyalität und niedrigere Customer Acquisition Cost. Building in Community ist damit die Vertiefung von Building in Public.

Beispiel: Capacities.io ist eine Note-Taking-Software, die Notizen auf die menschliche Wahrnehmung optimierte Weise strukturiert. Die Gründer haben eine Community aus 5000+ Menschen auf Discord aufgebaut, was den Support- & Onboarding-Aufwand reduziert und die Produktbindung erhöht.

2. Keine Angst vor der Nische

- Start in einer sehr klar definierten Nische mit spitzem Nutzer*inproblem.

- Nischen ermöglichen schnelles Verständnis von Marktbedürfnissen und zielgerichtetes Produktdesign.

- Hohe Eintrittsbarrieren für Wettbewerber*innen durch Expertise und Fokus.

- Nischen können nach und nach erweitert werden, um einen breiteren Markt zu erreichen.

Beispiel: parqet.com startete als FinTech für Portfolio-Tracking für die Kunden*innen einer einzigen Bank. Die Schritt-für-Schritt-Erweiterung der Services sorgte für stabiles Wachstum und ausreichend unternehmerischer Ressourcen.

3. Produktfokus: Gut Ding will Weile haben

- Produktqualität und Nutzer*inerlebnis wichtiger als schnelle Releases.

- Intensive Iterationsphasen mit frühen Nutzer*innengruppen.

- Launches werden verschoben, bis das Produkt wirklich überzeugt.

- Kund*innennähe (direktes Feedback, Support) ist der Hebel für Produktentwicklung.

Beispiel: PROJO ist ein SaaS für Planungsbüros in der Architektur und Ingenieurswesen. Die Software wurde mit den ersten drei Kunden über zwei Jahre bei regelmäßigen Check-ins verfeinert.

4. Nicht nach Version eins aufgeben

- Erste Versionen sind oft nicht erfolgreich – Fortschritt entsteht durch Ausdauer.

- Anpassungen, Repositionierungen und mehrere Iterationen können notwendig sein.

- Gründer*innen profitieren langfristig von Beharrlichkeit in derselben Produktlinie. Expertise in der Nische entsteht nicht sofort.

Beispiel: Gründer Sebastian Röhl entwickelt verschiedene Apps im Self-Improvement-Bereich, um herauszufinden, was funktioniert: WinDiary, HabitKit, LiftBear. Viele Gründer*innen berichten von einem Hockey-Stick-Moment

5. Teilzeitgründen gibt Sicherheit

- Viele Bootstrapped-Projekte starten erfolgreich neben dem Hauptjob.

- Reduzierte Arbeitszeit (z.B. 4-Tage-Woche) ermöglicht risikoreduziertes Wachstum.

- Nebenberufliche Projekte schaffen Zeit für Markttests und frühe Umsätze.

- Erst später in Vollzeit wechseln, wenn Traction vorhanden ist.

Beispiel: Treazy, ein Start-up für Socken, wurde vom Gründerduo in Teilzeit aufgebaut und beschäftigt heute beide voll. Ein(e) Gründer*in muss nicht alles stehen und liegen, um ein Start-up aufzubauen, oft reichen drei Tage oder die halbe Woche, was finanzielle Sicherheit gibt und ein langsameres Wachstum möglich macht.

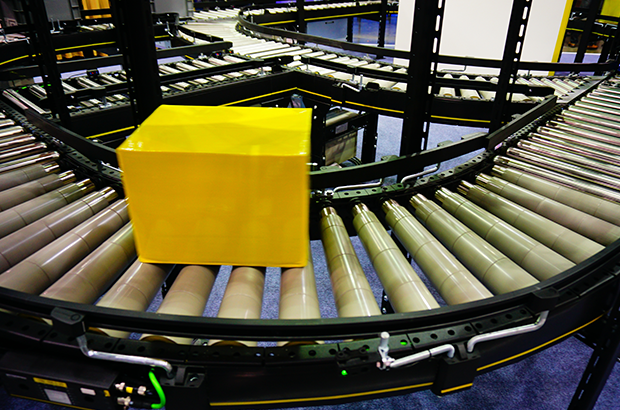

Intralogistik skalieren ohne Chaos

Wie Start-ups Materialflüsse früh professionalisieren und so typische Stolperfallen vermeiden können.

Effiziente Intralogistik ist ein unterschätzter Erfolgsfaktor für wachsende Start-ups. Wer Materialflüsse erst optimiert, wenn das Lager überläuft, handelt zu spät. Schon in der Aufbauphase lassen sich Strukturen schaffen, die Wachstum ermöglichen, statt es zu bremsen. Transparente Prozesse, digitale Schnittstellen und ergonomische Abläufe senken nicht nur Kosten, sondern sichern auch Qualität und Liefertreue. Der folgende Leitfaden zeigt, wie junge Unternehmen ihre Intralogistik schrittweise professionalisieren und typische Stolperfallen vermeiden können.

Frühzeitige Planung schafft Spielräume

Ein häufiger Fehler junger Unternehmen ist, Lager und Logistik nur als Nebenaufgabe zu betrachten. Dabei werden hier die Grundlagen für Liefergeschwindigkeit und Kundenzufriedenheit gelegt. Wer früh Flächenbedarf, Materialflusswege und Schnittstellen plant, spart später hohe Anpassungskosten. Auch einfache Tools wie Prozessdiagramme oder Lagerlayouts helfen, Engpässe zu erkennen. Besonders in der Wachstumsphase lohnt sich der Austausch mit spezialisierten Anbietern wie Toppy Deutschland, um geeignete Lösungen für Palettenhandling und Materialumschlag zu identifizieren.

Skalierbare Prozesse statt Ad-hoc-Lösungen

Wachstum bringt Komplexität. Viele Start-ups kompensieren diese mit mehr Personal, statt Abläufe zu automatisieren. Das führt langfristig zu Ineffizienz. Besser ist es, skalierbare Prozesse zu schaffen, die auch bei steigenden Stückzahlen stabil bleiben. Automatische Fördertechnik, modulare Regalsysteme und digitale Lagerverwaltungssysteme können hier entscheidend sein. Wichtig ist, in Prozessketten zu denken: Wareneingang, Kommissionierung, Verpackung und Versand müssen aufeinander abgestimmt sein. Nur so entstehen reibungslose Abläufe, die ohne ständige manuelle Eingriffe funktionieren.

Ergonomie und Arbeitssicherheit als Produktivitätsfaktor

In der Intralogistik entscheidet nicht nur Technik über Effizienz, sondern auch die Gestaltung der Arbeitsplätze. Zu hohe oder zu tiefe Greifpositionen, schwere Lasten und unübersichtliche Laufwege führen schnell zu Fehlern oder Ausfällen. Ergonomische Lösungen steigern Produktivität, weil sie Mitarbeitende entlasten. Mobile Palettenwechsler, höhenverstellbare Tische und automatische Hubsysteme reduzieren körperliche Belastungen und steigern gleichzeitig den Durchsatz. Ein ergonomisches Lager ist keine Kostenstelle, sondern ein zentraler Baustein für nachhaltige Effizienzsteigerung.

Digitalisierung gezielt einsetzen

Nicht jede digitale Lösung lohnt sich für jedes Start-up. Wichtig ist, zunächst die Prozesse zu verstehen, bevor Software eingeführt wird. Ein digitales Lagerverwaltungssystem bringt nur dann Vorteile, wenn Stammdaten gepflegt und Abläufe klar definiert sind. Sensoren, Scanner oder mobile Endgeräte können Fehlerquoten senken und Bestände in Echtzeit sichtbar machen. Entscheidend ist die Schnittstellenfähigkeit: Systeme müssen Daten austauschen können, um Medienbrüche zu vermeiden.

Kennzahlen und kontinuierliche Verbesserung

Effiziente Intralogistik lebt von Messbarkeit. Nur wer Prozesse kennt, kann sie verbessern. Relevante Kennzahlen sind unter anderem Durchlaufzeiten, Kommissionierfehler, Flächenauslastung und Lagerumschlag. Diese Daten liefern wertvolle Hinweise, wo Bottlenecks entstehen. Regelmäßige Auswertungen und kleine Anpassungen verhindern, dass sich Ineffizienzen einschleichen. Ein einfacher PDCA-Zyklus (Plan–Do–Check–Act) hilft, systematisch zu optimieren und schnell auf Marktveränderungen zu reagieren.

Investitionsentscheidungen mit System treffen

Investitionen in Lagertechnik oder Automatisierung sollten nie aus dem Bauch heraus erfolgen. Eine strukturierte Entscheidungsbasis ist unverzichtbar. Dazu gehören Wirtschaftlichkeitsrechnungen, Vergleich von Alternativen und Berücksichtigung von Wartungs- und Schulungskosten. Leasingmodelle oder Mietoptionen können sinnvoll sein, um Liquidität zu schonen. Ein Business Case zeigt, wann sich Investitionen amortisieren und welche Produktivitätsgewinne realistisch sind.

Beispielhafte Prüfkriterien vor einer Anschaffung:

- Reduziert die Lösung manuelle Arbeit oder Durchlaufzeit?

- Ist sie modular erweiterbar?

- Wie hoch sind Schulungs- und Wartungsaufwände?

- Passt sie zu vorhandenen Systemen?

- Gibt es eine messbare Effizienzsteigerung?

Nachhaltigkeit und Ressourceneffizienz

Auch im Lager ist Nachhaltigkeit längst ein Wettbewerbsfaktor. Energieeffiziente Fördertechnik, Mehrwegverpackungen und kurze Wege sparen Ressourcen und senken Kosten. Moderne Anlagen erfassen Energieverbrauch und Laufzeiten automatisch, um Optimierungspotenziale sichtbar zu machen. Ebenso wichtig: Mitarbeiter sensibilisieren, Abfall vermeiden und Materialflüsse gezielt steuern. Wer Nachhaltigkeit in die Intralogistik integriert, stärkt nicht nur das eigene Image, sondern profitiert von langfristig stabilen Betriebskosten.

Zusammenarbeit zwischen Produktion und Logistik

Häufig arbeiten Produktion und Logistik nebeneinander statt miteinander. Dabei entsteht Wertschöpfung nur, wenn Materialfluss und Fertigungsplanung ineinandergreifen. Kurze Abstimmungswege, klare Verantwortlichkeiten und gemeinsame Kennzahlen schaffen Transparenz. In kleineren Teams kann schon eine wöchentliche Abstimmung große Effekte bringen. Besonders bei der Einführung neuer Produkte sollten Materialfluss, Verpackung und Lagerstrategie von Beginn an gemeinsam gedacht werden. So lassen sich spätere Korrekturen und teure Nachrüstungen vermeiden.

Skalierung als Daueraufgabe verstehen

Intralogistik ist kein einmaliges Projekt, sondern ein kontinuierlicher Prozess. Mit wachsendem Auftragsvolumen ändern sich Anforderungen, Lieferketten und Kundenerwartungen. Wer regelmäßig prüft, ob Prozesse und Technik noch passen, bleibt wettbewerbsfähig. Auch Schulungen und Wissenstransfer sind wichtig, damit Teams Veränderungen mittragen. Der Aufwand zahlt sich aus: Eine skalierbare, flexible Logistikstruktur ist die Basis für stabiles Wachstum.

Interview mit Ole Dening: Wie digitalisieren Unternehmen ihre langfristigen Beschaffungsstrategien?

Ole Dening, Co-Founder der Partbase GmbH und Experte für digitale Einkaufslösungen, erklärt, wie Unternehmen mit digitalen Tools ihre langfristigen Beschaffungsstrategien effizienter gestalten.

Lieferketten, Einkauf und Beschaffung befinden sich im Wandel. Steigende Kosten, volatile Märkte und geopolitische Unsicherheiten zwingen Unternehmen dazu, ihre Strategien neu zu denken. Besonders im Einkauf zeigt sich, dass digitale Lösungen nicht mehr nur eine Option sind, sondern zur Notwendigkeit werden. Sie schaffen Transparenz, senken Risiken und ermöglichen eine strategische Planung, die weit über kurzfristige Bedarfsdeckung hinausgeht.

Wir haben mit Ole Dening über die Digitalisierung langfristiger Beschaffungsstrategien gesprochen. Er ist Experte für digitale Einkaufslösungen und weiß, wie Unternehmen moderne Plattformen in ihre Prozesse integrieren können. Ein Beispiel dafür ist die Partbase Plattform, die es ermöglicht, Rahmenverträge effizient zu verwalten, Lieferantenbeziehungen zu pflegen und Bestellprozesse zu automatisieren – ohne dabei den individuellen Charakter der Beschaffung zu verlieren.

Ziel solcher Systeme ist es, Einkäufern mehr Handlungsspielraum zu geben und sie von administrativen Aufgaben zu entlasten. Während früher Excel-Tabellen, E-Mails und Telefonate dominierten, setzen heute immer mehr Unternehmen auf zentrale Plattformen, die alle Informationen bündeln und die Kommunikation mit Lieferanten digital abbilden.

Ole Dening erklärt, warum langfristige Beschaffungsstrategien nur dann erfolgreich sind, wenn Technologie, Daten und persönliche Beziehungen sinnvoll kombiniert werden. Wir haben mit ihm über Herausforderungen, Erfolgsfaktoren und Zukunftsperspektiven des digitalen Einkaufs gesprochen.

StartingUp: Herr Dening, warum ist die Digitalisierung im Einkauf heute wichtiger denn je?

Ole Dening: Weil Unternehmen in einem Umfeld agieren, das von Unsicherheiten geprägt ist – Inflation, Lieferengpässe, geopolitische Risiken. Früher reichte Erfahrung, heute braucht es Daten, Automatisierung und Transparenz.

Gerade im MRO-Bereich (Maintenance, Repair & Operations) laufen viele Beschaffungsprozesse noch manuell ab – mit Excel-Listen, E-Mails und Telefonaten. Das kostet Zeit, Geld und ist fehleranfällig. Unsere Plattform Partbase digitalisiert diesen Prozess vollständig: Rahmenverträge, Lieferantenmanagement und Bestellungen werden automatisiert, Echtzeitdaten zu Preisen und Verfügbarkeiten integriert. Unternehmen reduzieren so ihre Prozesskosten um bis zu 30 % und gewinnen Zeit für strategische Aufgaben.

Ohne Digitalisierung droht Stillstand – und in dynamischen Märkten bedeutet das Wettbewerbsverlust.

StartingUp: Welche Rolle spielt Transparenz bei langfristigen Beschaffungsstrategien?

Ole Dening: Transparenz ist das Fundament jeder nachhaltigen Beschaffungsstrategie. Nur wer seine Lieferantenstruktur, Vertragslaufzeiten und Preisentwicklungen kennt, kann Risiken steuern und Chancen nutzen.

Partbase bietet dafür umfassende Transparenz: Aktuell knapp eine halbe Millionen Artikel, perspektivisch mehrere Millionen Artikel aus dem Bereich der Fluidtechnik (Hydraulik, Pneumatik und Drucklufttechnik), automatisierte Vertragsverwaltung, ERP-Anbindung (z. B. SAP) und Echtzeit-Dashboards zu Lagerbeständen und Lieferantenperformance.

Ein Kunde aus dem Maschinenbau stellte mit Partbase fest, dass 40 % seiner Komponenten von Single-Source-Lieferanten stammten – ein erhebliches Risiko. Durch alternative Angebote sank seine Ausfallquote um 25 %.

Transparente Daten schaffen Planungssicherheit, und Planungssicherheit ist die Grundlage strategischer Beschaffung.

StartingUp: Wie helfen Plattformen wie Partbase, ohne den persönlichen Kontakt zu Lieferanten zu verlieren?

Ole Dening: Digitale Plattformen ersetzen den persönlichen Kontakt nicht – sie verstärken ihn. Indem Routineaufgaben automatisiert werden, bleibt mehr Zeit für strategische Gespräche.

Bei Partbase nutzen Einkäufer Features wie das Collective Cart (teilbare Warenkörbe), mit dem Teams Bestellungen gemeinsam verwalten. Automatisierte Angebotserstellungen und ERP-Schnittstellen reduzieren den administrativen sowie kommunikativen Aufwand erheblich. Ein Kunde aus der Fertigung beschleunigte so seinen Bestellprozess um 40 %.

Gleichzeitig bleibt die persönliche Betreuung zentral: Unser Support reagiert innerhalb von 30 Minuten, und über Partner wie WK Hydraulik bieten wir technische Beratung, Reparaturen und Schulungen direkt vor Ort.

Kurz gesagt: Partbase digitalisiert Abläufe – nicht Beziehungen.

StartingUp: Warum ist die digitale Verwaltung von Rahmenverträgen so entscheidend?

Ole Dening: Rahmenverträge sind das Rückgrat jeder professionellen Beschaffung. Ihre Digitalisierung macht sie effizient, transparent und steuerbar.

Mit Partbase werden Verträge zentral verwaltet – mit Preisen, Laufzeiten und Konditionen in Echtzeit. Automatische Erinnerungen vermeiden Fristenversäumnisse, ERP-Anbindungen verknüpfen Verträge direkt mit Bestellungen.

So reduzieren Unternehmen den Verwaltungsaufwand um bis zu 50 % und erhöhen gleichzeitig die Preistreue. Dashboards liefern zudem Leistungsanalysen von Lieferanten, was gezielte Verhandlungen ermöglicht.

Das Ergebnis: weniger Aufwand, bessere Kontrolle, niedrigere Kosten.

StartingUp: Wo liegen die größten Herausforderungen bei der Einführung solcher Systeme?

Ole Dening: Vier Punkte treten regelmäßig auf:

1. Change-Management: Viele Mitarbeitende hängen an gewohnten Prozessen. Hier braucht es Schulung und Kommunikation, um den Mehrwert digitaler Tools zu vermitteln.

2. Datenqualität: Unvollständige oder veraltete Stammdaten bremsen die Automatisierung. Wir unterstützen Kunden bei der Bereinigung, bevor sie live gehen.

3. Systemintegration: Alte ERP-Systeme sind oft nicht standardisiert. Unsere APIs machen Anbindungen flexibel, erfordern aber initiale Abstimmung.

4. ROI-Verständnis: Manche Unternehmen zögern bei der Investition. Pilotprojekte zeigen schnell, dass sich die Einführung lohnt – häufig mit Einsparungen von 15 bis 25 %.

Mit klarem Projektplan, interner Kommunikation und starker Partnerbegleitung wird der Umstieg meist in wenigen Monaten erfolgreich abgeschlossen.

StartingUp: Wie wird sich die Beschaffung in den nächsten Jahren verändern?

Ole Dening: Die Zukunft des Einkaufs ist automatisiert, vernetzt und intelligent.

Digitale Plattformen übernehmen künftig viele operative Aufgaben: KI-gestützte Bedarfsplanung, Preisverhandlungen und Risikomanagement werden zum Standard. Partbase arbeitet bereits daran, diese Funktionen in seine Plattform zu integrieren.

Unsere Vision: Einkäufer konzentrieren sich auf strategische Themen –Lieferantenentwicklung, Innovationspartnerschaften, Nachhaltigkeit – während das System den Rest übernimmt.

Der menschliche Faktor bleibt entscheidend: Technologie ist nur dann erfolgreich, wenn sie den Menschen stärkt, nicht ersetzt.

Unternehmen, die jetzt digitalisieren, sichern sich nicht nur Effizienz, sondern Zukunftsfähigkeit.

StartingUp: Herr Dening, vielen Dank für das Gespräch.

Fazit: Digitale Plattformen wie Partbase zeigen, wie moderne Beschaffung funktioniert: transparent, automatisiert, aber dennoch menschlich. Sie verwandeln den Einkauf von einer reaktiven Kostenstelle in einen strategischen Werttreiber – besonders in der Industrie, wo Hydraulik, Pneumatik und Ersatzteilbeschaffung komplexe Prozesse sind.

Mit Vision zum Ziel: die Bedeutung einer klaren Strategie für jedes Unternehmen

Warum eine klare Unternehmensstrategie das Fundament für Wachstum, effiziente Entscheidungen und motivierte Mitarbeiter ist.

In der heutigen Geschäftswelt, die von schnellem Wandel und ständigem Wettbewerb geprägt ist, ist es leicht, den Fokus zu verlieren. Viele Unternehmen sind sehr beschäftigt und arbeiten hart, aber ohne eine klare Richtung, in die sie sich bewegen. Sie ähneln einem Schiff, das ohne Kompass aufs Meer sticht: Es mag viel Energie investieren, um voranzukommen, doch ohne einen festen Kurs wird es sein Ziel womöglich nie erreichen.

Genau hier kommt die Unternehmensstrategie ins Spiel. Sie ist wie ein Kompass und eine Landkarte zugleich. Sie definiert nicht nur, wohin das Unternehmen will, sondern auch, wie es dorthin gelangen kann. Eine gut durchdachte Strategie gibt allen Beteiligten Orientierung und stellt sicher, dass alle Anstrengungen in die gleiche Richtung zielen.

In diesem Artikel erfahren Sie, warum eine klare Strategie nicht nur ein nettes Beiwerk, sondern der entscheidende Grundpfeiler für den langfristigen Erfolg eines jeden Unternehmens ist.

Strategie als Kompass: Ziele klar definieren

Eine Unternehmensstrategie ist der Kompass, der sicherstellt, dass alle Anstrengungen in die richtige Richtung gehen. Sie hilft, eine klare Richtung und ein festes Ziel zu definieren. Ohne diese Orientierung laufen Unternehmen Gefahr, sich in Alltagsaufgaben zu verzetteln und den Blick für das Wesentliche zu verlieren. Es ist nicht genug, einfach nur hart zu arbeiten; man muss auch intelligent arbeiten. Die strategische Planung zwingt dazu, sich zu fragen: Was wollen wir in den nächsten fünf Jahren erreichen? Wer sind unsere Kunden? Was macht uns besser als die Konkurrenz?

Sobald diese Fragen beantwortet sind, kann man die Vision in messbare Ziele umwandeln. Ein hilfreiches Instrument dafür ist die Balanced Score Card. Sie übersetzt die übergeordnete Strategie in konkrete Kennzahlen, die alle Bereiche des Unternehmens – von den Finanzen über die Kunden bis hin zu den internen Prozessen – miteinander verbinden. So wird sichergestellt, dass beispielsweise eine Steigerung des Umsatzes nicht zu Lasten der Kundenzufriedenheit geht. Die Balanced Score Card hilft, das große Ganze im Blick zu behalten und die Strategie für alle Mitarbeiter verständlich zu machen. Sie dient als eine Art Checkliste, um zu überprüfen, ob alle Aktivitäten wirklich zur Erreichung der gesetzten Ziele beitragen.

Entscheidungsfindung und Ressourcenallokation

Ohne eine klare Unternehmensstrategie gleichen Entscheidungen oft einem Schuss ins Blaue. Manager und Mitarbeiter sind gezwungen, aus dem Bauch heraus zu handeln, was zu widersprüchlichen Ergebnissen und Ineffizienz führen kann. Eine gut definierte Strategie hingegen dient als Filter für alle Entscheidungen. Jede Idee, jedes Projekt und jede Investition kann danach bewertet werden, ob es die Unternehmensziele unterstützt. Das vereinfacht und beschleunigt den Entscheidungsprozess erheblich.

Eine Strategie hilft auch, Ressourcen – seien es finanzielle Mittel, Arbeitskraft oder Zeit – effizient zu verteilen. Anstatt Budget für verschiedene Projekte zu verschwenden, die möglicherweise nicht zum Erfolg beitragen, ermöglicht eine klare Strategie die Konzentration auf die wichtigsten Bereiche. Sie gibt den Rahmen vor, welche Prioritäten gesetzt werden müssen und wo Investitionen den größten Nutzen bringen. So wird sichergestellt, dass die knappen Mittel dort eingesetzt werden, wo sie die größte Wirkung entfalten.

Motivation und Mitarbeiterengagement

Eine klar kommunizierte Unternehmensstrategie ist ein starker Motivationsfaktor. Wenn Mitarbeiter die übergeordneten Ziele kennen, verstehen sie auch den Sinn ihrer eigenen Arbeit. Es ist ein großer Unterschied, ob man einfach nur Aufgaben abarbeitet oder weiß, wie der eigene Beitrag zum Gesamterfolg des Unternehmens beiträgt. Dieses Gefühl der Wichtigkeit und des Zusammenhalts stärkt das Engagement und die Loyalität.

Wenn alle im Team auf ein gemeinsames Ziel hinarbeiten, entsteht eine starke Gemeinschaft. Es beugt auch internen Konflikten vor, da alle Entscheidungen im Lichte der Strategie getroffen werden können. Eine Belegschaft, die sich mit der Vision des Unternehmens identifiziert, ist nicht nur produktiver, sondern auch kreativer und widerstandsfähiger gegenüber Herausforderungen.

Fazit: der Schlüssel zu nachhaltigem Wachstum

Eine klare Unternehmensstrategie ist das Herzstück für nachhaltigen Erfolg. Sie ist weitaus mehr als ein bloßes Dokument – sie ist der entscheidende Kompass, der dem Unternehmen eine Richtung gibt und sicherstellt, dass alle Anstrengungen in eine gemeinsame Richtung gehen. Eine Strategie schafft Fokus, vereinfacht die tägliche Entscheidungsfindung und ermöglicht es, die knappen Ressourcen effizient einzusetzen.

Vor allem aber ist eine Strategie ein starkes Werkzeug für die Mitarbeiter. Sie motiviert, stärkt das Engagement und schafft ein Gefühl der gemeinsamen Mission. Ohne diese klare Vision läuft ein Unternehmen Gefahr, sich in den Turbulenzen des Marktes zu verlieren. Eine strategische Planung mag anfangs aufwändig erscheinen, aber die Investition in eine klare Strategie ist letztlich die beste Investition in die Zukunft eines jeden Unternehmens.

Eine verrückte Utopie aus der Zukunft?

Die Wirtschaft der Zukunft wird zwangsläufig eine andere sein: Angesichts der Klimakrise bzw. der massiven Überbeanspruchung fast aller Ressourcen genügt es längst nicht mehr, nur weniger umweltschädlich zu handeln. Jan Schmirmund, Experte für regenerative Transformation und Innovation, will mit seinem neuen Buch „Regenerative Wirtschaft – Wie Pioniere eine lebenswerte Ökonomie gestalten“ (Murrmann Verlag) Mut machen, neue Wege zu gehen. Mehr dazu im Interview mit Jan.

Als Startup Advisor begleitest du auch junge Unternehmen auf ihrem Weg zu einer regenerativen Wirtschaftsweise. Was genau meint regeneratives Wirtschaften?

Regeneratives Wirtschaften bedeutet zunächst einmal, die Erkenntnis zuzulassen, dass wir als Menschen mitsamt unseren Organisationen untrennbar mit dem ökologischen System dieses Planeten verbunden und damit von ihm abhängig sind. Daraus folgt zwangsläufig, dass wir uns selbst schaden, wenn wir das System weiter zerstören – und dabei reicht es eben nicht aus, die Zerstörung nur etwas langsamer zu betreiben. Sprich: etwas weniger CO₂ auszustoßen, weniger Müll zu produzieren oder – um es mal pointiert zu sagen – die Kinder, die in deiner Lieferkette Produkte herstellen, nur noch bis zu den Knöcheln in der giftigen Chemiesuppe stehen zu lassen, statt vorher bis zu den Knien.

Der zweite Schritt ist dann, das eigene Handeln nach dieser Erkenntnis auszurichten. Mit reinen Optimierungsmaßnahmen im Sinne von „Do less harm“ wird man das Ziel nicht erreichen. Insbesondere dann nicht, wenn wir für ein Produkt zwar weniger Ressourcen benötigen, dafür aber umso mehr dieser Produkte herstellen. Am Ende wird der Schaden größer statt kleiner sein. Regeneratives Wirtschaften basiert daher auf einem anderen Ansatz: nämlich die Dinge von Grund auf anders zu machen – so, dass sie für den Planeten nützlich sind.

Ein Ansatz, der dieses Prinzip perfekt illustriert, ist Cradle to Cradle – also „von der Wiege zur Wiege“. Es geht dabei darum, Produkte so zu designen, dass die dort verwendeten Rohstoffe in perfekten Kreisläufen – biologischen oder technischen – unendlich oft wiederverwertet werden können. Das heißt: Jedes Material, das verbaut wurde, wird zum Rohstoff für neue Produkte. So soll ein ewiger Kreislauf ohne Müll entstehen.

In meinem Buch nutzt Michael Braungart, der Erfinder des Cradle-to-Cradle-Ansatzes und Professor an der Leuphana Universität in Lüneburg, das Beispiel eines Kirschbaums: Ein Kirschbaum reduziert nichts. Er spart auch nichts ein. Im Gegenteil: Er wuchert sogar mit Blüten und Früchten. Der Unterschied ist, dass diese nützlich für das ökologische System sind. Nach diesem Prinzip würde man auch nicht versuchen, Autoreifen zu produzieren, die weniger Mikroplastik abgeben, sondern der Abrieb wäre eben Rohstoff für die Natur. Das ist der Grundgedanke des gesamten regenerativen Wirtschaftens: ein nützlicher Teil des Gesamtsystems sein, der mit, vom und für das System wirkt – wie ein Baum im Wald.

Was dabei noch wichtig ist: Wachstum ist nichts Schlechtes, aber eben nicht unbegrenzt, so wie es gerade noch das Paradigma der degenerativen Wirtschaft ist. Wir sprechen in unserer Community daher auch lieber von Gedeihen als von Wachsen. Eine gedeihende regenerative Wirtschaft blüht wie ein Kirschbaum und bleibt dabei innerhalb der planetaren Grenzen und oberhalb der sozialen Fundamente, wie es Kate Raworth eindrucksvoll in ihrem Werk „Doughnut Economics“ beschreibt.

Gibt es Branchen, die für eine regenerative Transformation besonders gut geeignet sind?

Nicht in allen Branchen oder allen Unternehmen ist es gleich leicht. In der Landwirtschaft gibt es schon viele Betriebe, die regenerativ wirtschaften und Böden sowie Humus aufbauen, statt sie auszulaugen, oder zu einer Verbesserung der Biodiversität beitragen, statt nur weniger Arten auszurotten. Für andere Unternehmen, die beispielsweise Pflastersteine herstellen, liegen die Lösungen nicht direkt auf der Hand. Dennoch kann man sich auf den Weg machen. So zeigt etwa Luisa Rinn mit ihrem Unternehmen Rinn Betonsteine aus Gießen, dass auch hier vieles möglich ist.

Ja, es dauert vielleicht länger und ist mit Anstrengung verbunden. Das gilt für alle Branchen. Am Ende kommt es auf die individuelle Situation des Unternehmens an, wie leicht oder schwer es ist.

Wie können Start-ups als Innovationsträger aktiv zur regenerativen Transformation beitragen?

Da gibt es wirklich viele Wege. Start-ups haben es leichter als etablierte Unternehmen, weil sie die Chance haben, die Dinge von Grund auf richtig zu machen. Man kann sich als Start-up zum Beispiel direkt einen gemeinwohlorientierten und regenerativ ausgerichteten Purpose geben und das Unternehmen danach ausrichten. Und/oder man kann Leistungen anbieten, die es anderen Unternehmen erleichtern, regenerativ zu wirtschaften. In meinem Buch gibt es das Beispiel von Torsten Becker und seinem Start-up carbonauten aus Eberswalde. Torsten und sein Team produzieren über einen Pflanzenkohle-Ansatz Rohstoffe für Branchen wie Landwirtschaft, Bau oder Chemie, die es ermöglichen, CO₂-negative Produkte zu entwickeln. Oder nehmen wir das von Alma Spribille, Andreas Schmucker und Nico Tucher gegründete WEtell, einem Anbieter von Mobilfunkleistungen aus Freiburg, der regenerativ agiert, da durch das Design des Geschäftsmodells unter anderem mehr grüne Energie erzeugt wird, als durch die Nutzung der Mobilfunk-Infrastruktur entsteht.

Welche Schritte können Start-ups konkret gehen, um eine regenerative Wirtschaftsweise zu implementieren?

In einem vom BMWK geförderten Inkubatorprogramm, in dem ich mitwirke, zu finden unter www.reconnect-inkubator.org, helfen wir gemeinwohlorientierten Start-ups und KMU dabei, die drei wesentlichen Hebel für regeneratives Wirtschaften zu stärken. Dazu gehören neben der Kultur und dem Organisationsdesign auch das Geschäftsmodell und drittens – und ganz besonders – der Aufbau eines regenerativ ausgerichteten Business-Ökosystems, das ein Netzwerk bildet, das insgesamt regenerativ auf unsere ökologischen und sozialen Systeme wirkt.

Außer der Teilnahme an einem Inkubatorprogramm (und davon gibt es aktuell mehrere) kann man sich auch einen erfahrenen Berater ins Boot holen, sich um einen Platz in einem der Impact Hubs weltweit bemühen oder man startet erstmal ganz niederschwellig mit einem Buch. Das kann meines sein, wenn man ganz am Anfang steht, oder auch ein so tolles Werk wie „The Stellar Approach“ von TheDive in Berlin. Insbesondere als größeres Unternehmen sollte man sich aus meiner Sicht an eine erfahrene Transformationsberatung wenden.

Hast du Beispiele von jungen Unternehmen, die erfolgreich regenerative Ansätze verfolgen?

Oben habe ich ja schon ein paar Beispiele genannt. Weitere wären der Interior-Designer Sven Urselmann, der Zukunftsort „Wir Bauen Zukunft“ in Mecklenburg-Vorpommern, der Landwirtschaftsbetrieb Jucker Farm aus der Schweiz oder auch das Franz!Werk in Tübingen, das nach dem Prinzip gemeinschaftsbasierten Wirtschaftens, ähnlich dem bekannten Prinzip der solidarischen Landwirtschaft, arbeitet.

Weitere bekannte Beispiele sind die von Anna und Ran Yona gegründete Schuhmanufaktur Wildling aus Engelskirchen, die Suchmaschine Ecosia, die Firma hinter der Zeitschrift Neue Narrative (NN Publishing GmbH), der Verein Reinventing Society e.V. oder auch das 2021 von Dr. Joel Eichmann und Felix Wollenhaupt in Gießen gegründete Green Elephant Biotech. Es gäbe noch viel mehr Beispiele aufzuzählen; sie sind dabei alle unterschiedlich im Ansatz und auch im Fokus. Dennoch ist ihnen gemeinsam, dass sie als Vorbilder für eine neue Art des Wirtschaftens agieren und zeigen, dass es eben auch anders geht.

Umfragen zeigen, dass mehr als die Hälfte der deutschen Unternehmen die Umsetzung ethischer und nachhaltiger Ausgaben für zu kostspielig hält bzw. sich sorgt, dabei die finanzielle Stabilität aufs Spiel zu setzen. Was muss sich ändern, damit regenerative Transformation als wichtiger Schlüssel zu einer zukunftsfähigen und prosperierenden Wirtschaft erkannt und gelebt wird?

Puh. Komplexe Frage. Katrina Reuter, Geschäftsführerin des Bundesverbands Nachhaltiges Wirtschaften, vertritt die Auffassung, dass das Prinzip Freiwilligkeit bei Unternehmen gescheitert ist. Ich würde dem insofern zustimmen, als es ohne Leitplanken aus der Politik sehr schwer wird. Was wir aber vor allem auch brauchen, sind viele positive Beispiele, die anderen Unternehmer*innen zurufen: „Seht her, es geht. Auch für dich, denn die regenerative Wirtschaft ist keine verrückte Utopie aus ferner Zukunft, sondern sie ist schon da. Klein zwar, aber kraftvoll und deutlich anschlussfähiger an das Bestehende, als viele denken.“

Und, ganz wichtig: Regenerativ zu wirtschaften bedeutet nicht, auf irgendetwas zu verzichten. Im Gegenteil. Man tauscht vielmehr einen Haufen negativer Dinge gegen genauso viele positive ein. Und Geld darf man auch weiterhin verdienen. Viele der hier genannten Protagonisten zeigen das sehr deutlich und dokumentieren damit eindrucksvoll: Regeneratives Wirtschaften ist möglich.

Danke, Jan, für deine Insights

Den technologischen Wandel stemmen

Wie wir unsere Zukunft durch gezielte Fachausbildung in der Region sichern können.

Die Welt steht mitten in einem rasanten technologischen Wandel. Künstliche Intelligenz, Automatisierung und digitale Transformation prägen unsere Arbeitswelt und unseren Alltag. Die Frage, wie wir junge Menschen zu fähigen Fachkräften ausbilden können, wird immer drängender. Die technologischen Entwicklungen eröffnen auch für die Region und ihre Umgebung große Chancen, erfordern jedoch auch gezielte Bildungsangebote und ethisches Bewusstsein.

Regionale Perspektiven

Technologien wie maschinelles Lernen, Big Data, Robotik und das Internet der Dinge (IoT) eröffnen neue Möglichkeiten in der Industrie, im Dienstleistungssektor und darüber hinaus. Gleichzeitig verändern sie Berufsbilder grundlegend. Es ist daher von großer Bedeutung, die Weichen für eine zukunftsorientierte Ausbildung zu stellen.

In Kamen selbst gibt es keine eigenständige Hochschule, doch die Nähe zu Bildungseinrichtungen wie der Hochschule Hamm-Lippstadt (HSHL) und der Technischen Universität Dortmund bietet jungen Menschen Zugang zu innovativen Studiengängen mit technischem Fokus. Die HSHL bietet praxisnahe Studiengänge wie "Mechatronik" und "Angewandte Informatik", die auf die Anforderungen moderner Arbeitsmärkte abgestimmt sind. Die TU Dortmund hingegen überzeugt mit Studiengängen wie "Elektrotechnik und Informationstechnik" und "Maschinenbau". Diese Ausbildungen kombinieren theoretische Grundlagen mit praktischen Anwendungen und sind damit ein entscheidender Schlüssel zur Förderung von Fachkräften in der Region.

Ethische Fragen im neuen Zeitalter

Neben den Chancen, die der technologische Fortschritt bietet, werfen diese Entwicklungen auch ethische Fragen auf. Themen wie Datenschutz, digitale Regulierung und der Schutz vor einem “gläsernen Menschen“ werden immer wichtiger.

Ein Großteil der Datenerhebung findet bereits im alltäglichen Freizeitverhalten statt – oft, ohne dass sich die Nutzer dessen bewusst sind. Jede Interaktion im Internet hinterlässt Spuren: Beim Surfen akzeptieren viele Nutzer Cookies, die ihre Aktivitäten auf Webseiten verfolgen, um gezielte Werbung auszuspielen. Nur wenige bemühen sich, individuelle Einstellungen vorzunehmen, denn in Zeiten sofortiger Verfügbarkeit erwarten die meisten, dass alles im Handumdrehen geschehen soll.

Nicht zuletzt deswegen sind auch Registrierungsvorgänge bei Online-Diensten oder in Apps häufig unbeliebt. Dienstleister mit beschleunigten Verfahren, wie zum Beispiel Casinos ohne Anmeldung für schnelles Spielen, gewinnen an Beliebtheit. Außerdem sind hier umfassende Datenangaben nicht erforderlich und viele Nutzer fühlen sich dadurch wohler.

Auch in anderen Sektoren erfordern Anmeldeprozesse häufig die Preisgabe von persönlichen Daten wie Name, Geburtsdatum, Interessen und manchmal sogar Standortinformationen. Hinzu kommt die massive Datenerhebung durch mobile Geräte, die Bewegungsprofile aufzeichnen, Apps, die Zugriff auf Kontakte und Kameras fordern, und Sprachassistenten wie Alexa oder Google Assistant, die rund um die Uhr Sprachdaten sammeln können.

Solche Datenströme werden nicht nur für individuelle Dienste genutzt, sondern unter Umständen auch an Drittanbieter weitergegeben, was die Kontrolle über die eigenen Informationen erschwert. Mit der zunehmenden Nutzung von Daten zur Personalisierung von Dienstleistungen oder zur Effizienzsteigerung in Unternehmen wächst auch die Gefahr des Missbrauchs.

Ein weiterer bedenklicher Aspekt ist die gesellschaftliche Ungleichheit. Die digitale Transformation birgt die Gefahr, dass jene, die keinen Zugang zu moderner Technologie oder entsprechender Ausbildung haben, zurückgelassen werden. Daher müssen Ausbildungseinrichtungen nicht nur technische Kompetenzen vermitteln, sondern auch kritisches Denken und ethisches Bewusstsein fördern.

Lösungsansätze durch Bildung schaffen

Die Hochschulen der Region gehen hier mit gutem Beispiel voran: Die TU Dortmund bietet interdisziplinäre Ansätze, die ethische und gesellschaftliche Aspekte der Technologieentwicklung in den Fokus rücken. Die TU Dortmund legt großen Wert auf die Integration ethischer Reflexion in die Forschungspraxis. Auf Initiative von Prof. Dr. Christian Neuhäuser wird derzeit ein gemeinsamer Ethikrat für die Universitätsallianz Ruhr (UA Ruhr) vorbereitet, der die ethische Reflexion der Forschungspraxis fördern soll.

Zudem bietet die TU Dortmund Studiengänge und Projekte an, die über Fachgrenzen hinausgehen und ein Verständnis für komplexe Zusammenhänge fördern. Ein Beispiel hierfür ist das “studium oecologicum", ein Zertifikatsprogramm, das es Studierenden ermöglicht, sich intensiv und interdisziplinär mit Fragen der Nachhaltigkeit auseinanderzusetzen.

Studiengänge wie Soziologie oder Gesellschaftslehre an der Universität Duisburg-Essen und der Ruhr-Universität Bochum ermöglichen es, gesellschaftliche Veränderungen zu verstehen und aktiv mitzugestalten.

Diese Bildungsangebote sind von großer Bedeutung, da sie Studierenden nicht nur technisches Wissen, sondern auch ein tiefes Verständnis für die gesellschaftlichen und ethischen Implikationen der Technologieentwicklung vermitteln. Durch die Kombination von technischen und sozialwissenschaftlichen Studieninhalten werden zukünftige Fachkräfte darauf vorbereitet, technologische Innovationen verantwortungsbewusst zu gestalten und die gesellschaftlichen Auswirkungen ihrer Arbeit zu berücksichtigen.

Zukunft bewusst gestalten

Die jungen Menschen von heute stehen im Mittelpunkt dieses Wandels. Es ist unbedingt erforderlich, ihnen die Werkzeuge an die Hand zu geben, die sie benötigen, um nicht nur kompetente Fachkräfte, sondern auch verantwortungsbewusste Gestalterinnen und Gestalter der Zukunft zu werden.

Es bleibt die Aufgabe von Politik, Wirtschaft und Gesellschaft, diese Bemühungen zu unterstützen und den jungen Menschen eine Zukunftsperspektive zu bieten, die sowohl technologisch als auch ethisch nachhaltig ist.

Beobachten statt Berechnen

Rechnerische Planspiele und das Wissen um aktuelle Trends bringen Gründern erste Erkenntnisse über die Zukunft. Wichtiger ist das systematische Beobachten des konkreten Marktes, um ihn zu verstehen und aktiv mitzugestalten.

Natürlich gehört das Glänzen auf dem Theorie-Parkett und das Schreiben von zahlenbasierten Businessplänen für Gründer zum Pflichtprogramm, um beispielsweise der Hausbank zu zeigen, wie man am Markt einsteigen und bestehen will; aber es kann und darf nicht zum Selbstzweck werden und vollständig das überlagern, weswegen der ganze Aufwand eigentlich betrieben wird: Nämlich mit vollem Einsatz ein unternehmerisches Konzept zu erarbeiten, es umzusetzen und unermüdlich weiterzuentwickeln.

Denn nicht nur für aus der Not heraus geborene Gründungen gilt, dass sie stets ein Wagnis darstellen; und zwar eben nicht nur ein betriebswirtschaftliches. Dass sie mit der Person des Gründers oder der Gründerin untrennbar zusammenhängen. Und dass sie entscheidend darauf beruhen, dass die Neu-Unternehmer den Einsatz und Willen haben, etwas zu gestalten!

Wie geht das, ein spezielles Markt-Umfeld – in der Regel eine Nische, ein Regionalmarkt oder ein enger Zielgruppen-Fokus – langsam und stetig (erstens) entlang klarer, konkreter, auf das eigene Unternehmen zugeschnittener Marktqualitätskriterien zu entwickeln und (zweitens) anhand von Indikatoren für eine Marktdynamik auch in der Richtung, in die man selber will, zu lenken? Dieser Kernfrage wollen wir uns im Folgenden widmen.

Strategic Foresight

Im angelsächsischen Kulturkreis ist für derlei Fragestellungen bereits seit Jahrzehnten eine Profession zuständig – und bestens etabliert –, die sich ausschließlich um genau solche Markt-Taktik und Business-Manöver kümmert: Strategic Foresight, die Zukunftsforschung. Hierzulande ist allerdings, wenn überhaupt, eher der Ableger der Trendforschung bekannt. Und das auch fast nur in Großunternehmen oder einigen Lifestyle-Branchen, die sich’s leisten können. Ansonsten stößt Zukunftsforschung auf Skepsis – nicht zuletzt dank einiger Trend-Gurus, die unverdrossen am eigenen Ruf basteln und lustige Trend-Labels und vielerlei Spielchen erfinden. Mit durchaus hohem Unterhaltungs-, aber allem Anschein nach wenig Gebrauchswert. Zukunftsforschung rangiert daher in der Einschätzung vieler gleich hinter „Astrologie 2.0“. Was aber ist wirklich dran an dieser scheinbar exotischen Disziplin?

10 Regeln fürs schnelle und günstige Testen von Ideen

Wer eine Geschäfts- oder Produktidee hat und diese schnell und ohne großen finanziellen Aufwand testen möchte, kommt am Lean-Ansatz kaum vorbei.