Aktuelle Events

Wie Start-ups mit KI und Low-Code durchstarten können

Angesichts des Drucks der fortschreitenden Digitalisierung und des Fachkräftemangels bietet KI-gestütztes Coding vielversprechende Chancen, gerade auch für Start-ups.

Die Analysten von Gartner gehen davon aus, dass bis 2028 drei von vier Softwareentwicklern in Unternehmen KI-Assistenten beim Programmieren einsetzen werden. Das ist ein deutlicher Anstieg gegenüber Anfang 2023, als der Anteil noch unter zehn Prozent lag. Start-ups sind aufgrund ihrer Agilität und ihres Innovationsgeistes besonders gut aufgestellt, um KI-Tools zu nutzen und ihre Programmierprozesse grundlegend zu verändern. Angesichts des Drucks der fortschreitenden Digitalisierung und des Fachkräftemangels bietet KI-gestütztes Coding vielversprechende Chancen. Low-Code-Plattformen ermöglichen es Start-ups, dieses Potenzial effektiv zu nutzen.

KI und generative KI (GenAI) stellen eine Herausforderung für die traditionelle Softwareentwicklung dar. Daher haben die Diskussionen über ihre möglichen Auswirkungen in den letzten Jahren stark zugenommen. Eines ist jedoch klar: diese Technologie verspricht, die Softwareentwicklungsprozesse von Unternehmen deutlich effizienter zu gestalten.

Die rasante Entwicklung im Bereich der künstlichen Intelligenz bedeutet, dass beispielsweise bestimmte Aufgaben wie die Dokumentation von Quellcode für die Wartbarkeit und das Schreiben neuen Codes laut McKinsey nur noch halb so viel Zeit in Anspruch nehmen. Gartner prognostiziert, dass KI-gestütztes Programmieren die Produktivität menschlicher Entwickler in naher Zukunft um das Zehnfache steigern kann. Für Start-ups, die KI-unterstützte Programmierung einsetzen, bedeutet dies schnellere Entwicklungszyklen und weniger Zeitaufwand für die Wartung. Dies setzt jedoch einen durchdachten Coding-Ansatz voraus, der es Start-ups ermöglicht, in einem zunehmend komplexen Markt flexibel zu bleiben, ohne Kompromisse bei der Sicherheit einzugehen.

Die Macht von KI und generativer KI im Coding von morgen

Start-ups sollten die Einführung von KI-gestützter Programmierung sorgfältig abwägen und mit den richtigen Sicherheits-Tools kombinieren, um ihre Agilität zu erhalten und Innovationen voranzutreiben. KI, und insbesondere generative KI, kann Entwicklern dabei helfen, Code schneller und mit weniger Fehlern zu schreiben und zu verfeinern. Diese Technologien können wiederkehrende Aufgaben automatisieren, Code-Verbesserungen vorschlagen und sogar neue Code-Fragmente generieren. Dadurch wird der Zeit- und Arbeitsaufwand für die Softwareentwicklung erheblich reduziert.

Üblicherweise dauert die Entwicklung von Software von der Idee bis zum marktreifen Produkt im besten Fall Monate – im realistischen Szenario jedoch Jahre. Eine erfolgreiche Anwendung durchläuft dabei einen stringenten Planungs- und Entwurfsprozess, bevor mit der Programmierung, dem Testen und Debuggen begonnen werden kann. Auch nach der Bereitstellung ist eine kontinuierliche Wartung erforderlich, um sicherzustellen, dass die Software reibungslos läuft und Aktualisierungen und Leistung den wachsenden Anforderungen entsprechen. In der Realität sind für die meisten dieser Prozesse Tech-Experten zuständig, was zu Verzögerungen und Ineffizienz führt, da Nachfrage und die verfügbaren Ressourcen meist nicht im Gleichgewicht sind.

KI ersetzt keine Developer-Expertise

Bei jedem Update von ChatGPT werden Stimmen laut, die postulieren, dass diese Version die traditionelle Entwicklung abschafft und es jedem ermöglicht, ein Entwickler zu sein. In der Realität ist das Programmieren mit Hilfe von KI jedoch kein Ersatz für technische Expertise. Der Einsatz von KI in der Programmierung hat zwar ein enormes Potenzial, die Geschwindigkeit zu erhöhen, aber die sporadischen Ungenauigkeiten der KI-Halluzinationen erfordern technische Unterstützung, um die Qualität des Codes zu erhalten und Schwachstellen zu vermeiden. (Zur Info: Spricht man im Rahmen der KI von einer Halluzination, ist damit ein überzeugend aussehendes KI-generiertes Ergebnis in Text- oder Bildform gemeint, das nicht durch Trainingsdaten objektiv belegt werden kann und damit weitgehend erfunden ist.)

Denn öffentlich verfügbare KI-Modelle werden auf öffentlich zugänglichen Codebasen trainiert – und ein erheblicher Teil davon ist naturgemäß fehlerhaft. Mit anderen Worten: Die Qualität der Daten, mit denen die generativen Modelle gefüttert werden, und die daraus resultierenden Modelle selbst, sind alles andere als perfekt.

Low-Code und KI – ein starkes Duo für Gründer*innen

Um schnell innovativ zu sein und agil zu bleiben, müssen Unternehmen die Einführung von KI mit Lösungen kombinieren, die solide Leitlinien und Governance gewährleisten, um den resultierenden Code vor Schwachstellen und Fehlern zu schützen.

Neben der Frage der Einführung von KI in der Softwareentwicklung, führt der anhaltende Fachkräftemangel weiterhin dazu, dass IT-Teams die wachsenden Aufgaben in der immer komplexeren IT-Landschaft nicht bewältigen können. Das bedeutet, dass Unternehmen, neben dem Einsatz von KI zur Verbesserung der Programmiereffizienz, Wege finden müssen, um ihre Mitarbeitenden weiterzubilden und breitere Teams in die Ideenfindung und Entwicklung einzubeziehen.

In diesem Zusammenhang spielt die Low-Code-Technologie eine zentrale Rolle, weil sie nicht nur die Entwicklung sicherer und robuster Anwendungen gewährleistet, sondern auch wesentlich zur Demokratisierung der Softwareentwicklung beiträgt. Das bedeutet, dass in der Praxis Fachbereichs-übergreifende „Fusion Teams“ entstehend, die Teammitglieder ohne tiefes technisches Wissen in die Lage versetzen, während des gesamten Innovations- und Softwareentwicklungsprozesses mit den IT-Profis zusammenzuarbeiten. Aus der Entwicklungsperspektive trägt dies auch dazu bei, die Qualität der entwickelten Software zu erhöhen, da die künftigen Nutzer*innen von Anfang an einbezogen werden. Außerdem werden dadurch Silos innerhalb der traditionellen Softwareentwicklungsprozesse aufgebrochen und der Austausch von Wissen und Feedback erleichtert. Dies rationalisiert die Entwicklung und beseitigt personelle Engpässe. Ermöglicht wird dies durch die visuelle Natur von Low-Code: Prozess- und Anwendungsmodelle lassen sich durch Visualisierung leichter entwerfen und Designentscheidungen können zügig iteriert werden.

Enterprise-Low-Code-Plattformen mit eingebetteten KI-Funktionen können auch komplexe Entwicklungsaufgaben durch die Automatisierung von Routineprozessen, und die Generierung von Code-Vorschlägen rationalisieren. Darüber hinaus werden die Entwicklungszyklen durch ein schnelles Prototyping, Testen und Skalieren verbessert, was für den Erfolg von Start-ups unerlässlich ist.

Mit dem umsichtigen Einsatz von KI zum unternehmerischen Erfolg

Die Kombination aus Low-Code und KI hat somit viele Vorteile für Start-ups: komplexe manuelle Programmierung wird reduziert, die Kollaboration von gemischten Teams gefördert, indem nicht-technische Mitarbeitende befähigt werden sich einzubringen; das entlastet die IT-Abteilung und Unternehmen können schneller auf sich ändernde Anforderungen reagieren. Durch die Verringerung des Zeitaufwands können sich Mitarbeitende mehr auf ihre Kreativität und die strategische Planung konzentrieren, was sich positiv auf die Innovationsgeschwindigkeit und deren Umfang auswirkt. Mit der gewonnenen Agilität und verbesserten Effizienz können Start-ups mit größeren und reiferen Unternehmen konkurrieren, weil sie sich schnell an Marktveränderungen und Kund*innenbedürfnisse anpassen.

Die Verwendung von KI in der Programmierung ist entscheidend für Start-ups, um ihre Innovationen zu katalysieren. Sie müssen sich jedoch der Grenzen von KI bewusst sein und die KI-gestützte Programmierung unter Berücksichtigung von Governance und Sicherheit angehen. Gerade für Start-ups, die ein schnelles Wachstum anstreben, kann dieser ausgewogene Ansatz ein entscheidender Erfolgsfaktor sein.

Der Autor Tim Herden ist Director Solution Architecture DACH & Nordics bei bei Mendix. Das Siemens-Unternehmen ist die einzige Low-Code-Plattform, die für die gesamte Komplexität der Softwareentwicklung in Unternehmen ausgelegt ist.

Diese Artikel könnten Sie auch interessieren:

Was macht das „perfekte Give-away“ auf einer Messe aus?

Erfahren Sie hier mehr dazu, wie das „perfekte Give-away“ für Messen und Co. aussieht.

Messen gehören weiterhin zu den wichtigsten Plattformen für Neukundengewinnung, Markenpräsentation und Geschäftsanbahnung. Trotz zunehmender Digitalisierung bleibt der persönliche Kontakt für viele Unternehmen ein entscheidender Erfolgsfaktor. Gerade deshalb spielt auch die Auswahl passender Give-aways eine wichtige Rolle. Werbegeschenke gehören seit Jahrzehnten zum festen Bestandteil von Messeauftritten und sollen Aufmerksamkeit erzeugen, Gespräche fördern und langfristig in Erinnerung bleiben.

Allerdings hat sich die Erwartungshaltung rund um klassische Werbeartikel deutlich verändert. Ein einfacher Kugelschreiber oder ein günstiger Streuartikel reicht heute oft nicht mehr aus, um nachhaltig wahrgenommen zu werden. Besucher achten stärker auf Nutzen, Qualität, Nachhaltigkeit und Design. Das perfekte Give-away erfüllt deshalb mehrere Funktionen gleichzeitig: Es schafft Wiedererkennung, transportiert Markenwerte und besitzt einen tatsächlichen Mehrwert im Alltag. Die folgenden Abschnitte liefern hierzu einige spannende Inspirationen.

Der praktische Nutzen entscheidet über den eigentlichen Wert

Einer der wichtigsten Faktoren für erfolgreiche Give-aways bleibt der praktische Nutzen. Werbeartikel, die regelmäßig verwendet werden, sorgen automatisch für eine höhere Sichtbarkeit der Marke. Genau deshalb gewinnen funktionale Produkte seit Jahren an Bedeutung.

Besonders beliebt sind langlebige Alltagsgegenstände wie Notizbücher, Ladegeräte oder Trinkflaschen. Vor allem hochwertige und nachhaltige Produkte erzeugen häufig einen deutlich besseren Eindruck als günstige Massenware. Unternehmen setzen deshalb zunehmend auf individuell gestaltete Werbeartikel mit langfristigem Nutzwert. Eine personalisierte Trinkflasche von Flaschenfreunde.de verbindet beispielsweise Funktionalität, Nachhaltigkeit und Markenpräsenz in einem Produkt. Gerade auf Messen können solche Artikel langfristig sichtbar bleiben, weil sie im Büro, unterwegs oder beim Sport regelmäßig genutzt werden.

Hinzu kommt der Nachhaltigkeitsaspekt. Wiederverwendbare Produkte wirken moderner und verantwortungsbewusster als kurzlebige Werbeartikel aus Plastik. Viele Unternehmen achten deshalb bewusst darauf, Give-aways auszuwählen, die Umweltbewusstsein und Markenimage gleichzeitig unterstützen.

Qualität statt Masse

Früher lag der Fokus vieler Messeauftritte auf möglichst großen Mengen günstiger Werbeartikel. Heute verändert sich diese Strategie zunehmend. Hochwertige Give-aways erzielen oft eine stärkere Wirkung als große Stückzahlen einfacher Streuartikel.

Besucher verbinden die Qualität eines Give-aways häufig direkt mit der Qualität eines Unternehmens. Ein schlecht verarbeitetes Produkt kann dadurch sogar einen negativen Eindruck hinterlassen. Hochwertige Materialien, ansprechendes Design und eine sinnvolle Verpackung gewinnen deshalb an Bedeutung.

Besonders im B2B-Bereich spielt Wertigkeit eine große Rolle. Geschäftspartner und potenzielle Kunden erwarten professionelle Präsentationen und durchdachte Markenauftritte. Ein hochwertiges Give-away signalisiert Aufmerksamkeit und schafft einen positiveren Gesamteindruck.

Dabei muss ein gutes Werbegeschenk nicht zwangsläufig teuer sein. Entscheidend bleibt vor allem die Kombination aus Nutzen, Gestaltung und Zielgruppenrelevanz.

Der Faktor Zielgruppenorientierung wird immer wichtiger

Das „perfekte Give-away“ funktioniert nicht für jede Branche oder Zielgruppe gleichermaßen. Unternehmen müssen deshalb genau analysieren, welche Produkte tatsächlich zu den Interessen ihrer Besucher passen.

Technologieunternehmen setzen häufig auf praktische Büroartikel oder digitale Gadgets, während nachhaltigkeitsorientierte Marken eher auf wiederverwendbare Produkte oder ökologische Materialien achten. Auch Alter, Berufsfeld und Nutzungskontext spielen eine wichtige Rolle.

Gerade auf Fachmessen gewinnt Personalisierung an Bedeutung. Besucher möchten keine beliebigen Werbeartikel mehr sammeln, sondern Produkte erhalten, die tatsächlich relevant wirken. Individuell ausgewählte Give-aways erhöhen deshalb die Wahrscheinlichkeit, dass ein Artikel langfristig genutzt wird.

Zusätzlich kann ein Give-away die Markenbotschaft direkt unterstützen. Unternehmen mit Fokus auf Innovation wählen häufig moderne Technologien, während traditionelle Marken stärker auf klassische und langlebige Produkte setzen.

Auch ein wichtiges Thema: Kundenbindung im Online-Handel durch Give-aways

Give-aways spielen längst nicht mehr nur auf Messen eine wichtige Rolle. Auch im Online-Handel gewinnen kleine Zusatzprodukte zunehmend an Bedeutung, wenn es um Kundenbindung und Markenwahrnehmung geht.

Viele Unternehmen legen Bestellungen kleine Geschenke, Rabattcodes oder personalisierte Artikel bei, um das Einkaufserlebnis emotional aufzuwerten. Gerade im E-Commerce fehlt häufig der persönliche Kontakt, den stationäre Geschäfte oder Messen automatisch erzeugen. Zusätzliche Give-aways können diese Distanz teilweise ausgleichen.

Besonders wirkungsvoll sind oft Produkte, die einen echten Mehrwert bieten und regelmäßig genutzt werden. Dadurch bleibt die Marke auch nach dem Kauf dauerhaft präsent. Gleichzeitig erhöhen hochwertige Zugaben oft die Wahrscheinlichkeit von Wiederbestellungen oder positiven Bewertungen.

Darüber hinaus fördern Give-aways im Online-Handel häufig die Sichtbarkeit in sozialen Netzwerken. Kreative oder hochwertige Produkte werden eher fotografiert, geteilt oder weiterempfohlen und erzeugen dadurch zusätzliche Reichweite.

Ein besonderer Trend: Smarte Gadgets in unterschiedlichen Preisklassen

Neben klassischen Werbeartikeln gewinnen smarte Gadgets zunehmend an Bedeutung. Besonders auf technologieorientierten Messen oder im B2B-Umfeld wirken moderne Produkte häufig innovativer und zeitgemäßer.

Dabei existieren, wie auf den Seiten von homeandsmart immer wieder zu sehen ist, inzwischen zahlreiche Lösungen in unterschiedlichen Preisklassen. Günstigere Varianten umfassen beispielsweise Webcam-Abdeckungen, Smartphone-Halter oder kleine USB-Accessoires. Im mittleren Segment sind Powerbanks, Bluetooth-Tracker oder kabellose Ladegeräte beliebt.

Hochwertigere Give-aways setzen häufig auf technische Innovation und Premium-Charakter. Dazu gehören beispielsweise smarte Trinkflaschen, kabellose Kopfhörer oder multifunktionale Reisegadgets.

Solche Produkte erzeugen meist eine stärkere emotionale Wirkung, werden jedoch gezielter an wichtige Geschäftspartner oder Bestandskunden vergeben.

Entscheidend bleibt auch hier die Zielgruppenrelevanz. Nicht jedes Gadget passt automatisch zu jeder Marke. Unternehmen sollten deshalb darauf achten, dass technische Give-aways tatsächlich sinnvoll wirken und nicht ausschließlich als kurzfristiger Effekt dienen.

Nachhaltigkeit wird zum entscheidenden Faktor

Nachhaltigkeit entwickelt sich zunehmend zu einem zentralen Auswahlkriterium bei Werbeartikeln. Viele Besucher achten heute bewusst darauf, ob Give-aways langlebig, wiederverwendbar oder ressourcenschonend produziert sind.

Kurzlebige Plastikprodukte verlieren deshalb an Bedeutung. Stattdessen setzen Unternehmen häufiger auf Materialien wie Edelstahl, Glas, Holz oder recycelte Stoffe. Auch regionale Produktion und faire Herstellungsbedingungen gewinnen an Relevanz.

Nachhaltige Give-aways stärken nicht nur das Markenimage, sondern erhöhen oft auch die tatsächliche Nutzungsdauer eines Produkts. Werbegeschenke mit Umweltbezug wirken dadurch häufig hochwertiger und glaubwürdiger.

Gerade jüngere Zielgruppen reagieren zunehmend sensibel auf unnötige Wegwerfartikel. Unternehmen, die bewusst nachhaltige Lösungen einsetzen, können sich deshalb klar positiver positionieren.

Emotionale Wirkung bleibt im Fokus

Das perfekte Give-away erfüllt letztlich weit mehr als eine rein praktische Funktion. Es soll Aufmerksamkeit erzeugen, positive Emotionen auslösen und die Marke langfristig im Gedächtnis verankern.

Besonders erfolgreich sind oft Werbeartikel, die Überraschung, Qualität und Alltagstauglichkeit miteinander verbinden. Besucher erinnern sich oft weniger an den eigentlichen Messestand als an Produkte, die später regelmäßig genutzt werden.

Dabei spielt auch die Übergabe eine Rolle. Persönlich überreichte Give-aways wirken häufig wertiger als anonym verteilte Streuartikel. Gespräche, Beratung und individuelle Ansprache verstärken zusätzlich die emotionale Bindung.

Gerade deshalb investieren viele Unternehmen heute stärker in kleinere, aber hochwertigere Give-away-Konzepte statt in große Mengen austauschbarer Produkte.

Fazit

Das perfekte Give-away auf einer Messe kombiniert Nutzen, Qualität, Zielgruppenrelevanz und Markenwirkung. Während einfache Streuartikel zunehmend an Bedeutung verlieren, gewinnen hochwertige und nachhaltige Produkte immer stärker an Aufmerksamkeit.

Besonders funktionale Alltagsgegenstände, smarte Gadgets und personalisierte Produkte bleiben langfristig sichtbar und stärken die Markenpräsenz deutlich effektiver als kurzfristige Werbeartikel ohne Mehrwert. Gleichzeitig spielen Nachhaltigkeit und emotionale Wirkung eine immer größere Rolle.

Unternehmen, die Give-aways strategisch auswählen und konsequent an Zielgruppe und Markenimage ausrichten, schaffen nicht nur mehr Aufmerksamkeit auf Messen, sondern stärken langfristig auch oft die Kundenbindung und die Wiedererkennung.

5 Mio. Euro für die „Schreibtischlosen“: Kann Elephant den Frontline-Markt wirklich digitalisieren?

Operative Teams in der Produktion, der Logistik oder im Service gelten bei der Digitalisierung oft als vernachlässigt. Das Berliner Start-up Elephant verspricht Abhilfe durch KI-gestütztes Micro-Learning und sicherte sich dafür nun 5 Millionen Euro. Doch zwischen dem PR-Versprechen und der harten Shopfloor-Realität warten ein eng besetzter Markt und die Gefahr der technologischen Austauschbarkeit.

Die aktuelle Finanzierungsrunde wird von den Corporate-Venture-Capital-Einheiten (CVC) EnBW New Ventures und Wepa angeführt. Dass ausgerechnet diese Player investieren, ist kein Zufall: Die Mutterkonzerne steuern selbst riesige operative Belegschaften. Sie dienen der Elephant Technologies GmbH somit nicht nur als Geldgeber, sondern gleichzeitig als Testlabor und Referenzkund*innen. Ergänzt wird die Runde durch namhafte Angel-Investoren aus dem Umfeld von Flix und Home24.

Das Geschäftsmodell: KI-Kurse gegen das „Wissens-Leck“

Die Gründer Maurice Zomorrodi, Niklas Dehio und Melchior Schramm riefen Elephant im Sommer 2022 ins Leben. Sie adressieren ein strukturelles Problem: Wissen wird in operativen Betrieben oft noch mündlich oder über veraltete Handbücher weitergegeben. Die Elephant-Plattform nutzt einen KI-gestützten „Coursebuilder“, um aus bestehenden Dokumenten mit wenigen Klicks interaktive Lerneinheiten für eine mobile App zu generieren. Ein KI-Assistent soll Fragen zudem kontextbezogen direkt am Arbeitsplatz beantworten. Um Sprachbarrieren in der Industrie abzubauen, bietet das System Übersetzungen in über 95 Sprachen. Dass das Modell Anklang findet, zeigt sich am Solar-Einhorn Enpal, das Elephant zur Schulung von Quereinsteigern nutzt.

Journalistisch betrachtet muss man jedoch das Preisschild hinterfragen: Der Einstieg in die Plattform beginnt bei 640 Euro monatlich für bis zu 50 Nutzer*innen („Team“) und skaliert über 1.300 Euro („Pro“) bis hin zu Enterprise-Lösungen ab 4.000 Euro im Monat. Für Mittelständler*innen ist das ein beachtlicher Kostenblock, der sich zügig durch messbar sinkende Fehlerquoten oder kürzere Onboarding-Zeiten rechtfertigen muss.

Ein Markt im Goldrausch: Wer sind die Jäger*innen?

Elephant ist längst nicht allein auf der Jagd nach der „Deskless Workforce“. Dieses enorme Segment hat in den letzten Jahren mächtige Wettbewerber auf den Plan gerufen. So hat beispielsweise der Branchen-Riese Beekeeper die Frontline-Trainingsplattform eduMe nahtlos in seine App integriert, um Mitarbeitenden Weiterbildung mit nur einem Klick zugänglich zu machen. Solche Konsolidierungen zeigen: Der Standard im operativen Weiterbildungsmarkt wird zunehmend höher.

Zwischen Innovation und Commodity

Trotz des Kapitalschubs steht das Start-up vor zwei entscheidenden Hürden. Erstens droht der technologische Kern – das Umwandeln von PDFs in Quizze mittels KI – zu einer reinen „Commodity“ zu werden. Da große Sprachmodelle (LLMs) rasant mächtiger werden, könnten generische Unternehmenstools diese Funktion bald als Standard-Feature mitliefern. Elephant muss beweisen, dass sich die Plattform unverzichtbar tief in echte Qualitätssicherungs- und Produktionsprozesse verwebt.

Zweitens bleibt der Faktor Mensch das größte Risiko. Software für den Shopfloor scheitert selten am Management, sondern oft an der fehlenden Akzeptanz der Belegschaft. Wenn die App im stressigen Arbeitsalltag nicht als spürbare Entlastung wahrgenommen wird, nützt auch die beste KI wenig.

Unser Fazit

Ein valider Ansatz unter hohem Konkurrenzdruck Elephant hat mit EnBW und Wepa die idealen Partner gefunden, um die Praxistauglichkeit in großen Strukturen unter Beweis zu stellen. Die 5 Millionen Euro geben den nötigen Runway. Dennoch ist der technologische Burggraben schmal. Um langfristig gegen internationale Schwergewichte zu bestehen, muss Elephant mehr sein als nur ein komfortabler Content-Generator. Der echte Härtetest beginnt an der Werkbank.

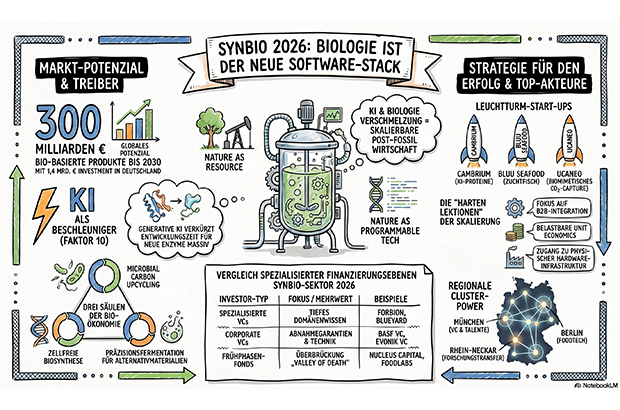

SynBio-Start-up-Report 2026

Biologie ist der neue Code: Wie Synthetische Biologie (SynBio) die Industrie neu programmiert und welche Start-ups dabei hierzulande federführend sind.

Die Vision einer post-fossilen Wirtschaft ist im Jahr 2026 keine bloße Utopie mehr, sondern eine präzise Ingenieursleistung. Wir erleben den Moment, in dem die Natur von einer Ressource, die wir ausbeuten, zu einer Technologie wird, die wir programmieren. In den Laboren der Republik entstehen heute Lösungen für die größten Versorgungskrisen unserer Zeit. Der Aufstieg der Synthetischen Biologie (SynBio) markiert den Übergang vom Zeitalter der Petrochemie in das Zeitalter der Biomanufaktur – eine Transformation, die so tiefgreifend ist wie die industrielle Revolution, jedoch mit der Geschwindigkeit der digitalen Transformation erfolgt.

Wenn Bits auf Atome treffen

Der SynBio-Markt ist 2026 in eine Phase der industriellen Skalierung eingetreten. Aktuelle Analysen der KfW sowie Branchenberichte von BCG beziffern das globale Marktpotenzial für bio-basierte Produkte bis Ende des Jahrzehnts auf über 300 Milliarden Euro. Allein in Deutschland ist das Investitionsvolumen in DeepTech-BioTech-Start-ups im vergangenen Geschäftsjahr laut Bitkom-Daten auf einen Rekordwert von 1,4 Milliarden Euro gestiegen. Der entscheidende technologische Katalysator ist die Verschmelzung von Generativer KI und Biologie. Dank Modellen, die Proteinfaltungen präziser vorhersagen können, als es je ein menschlicher Forscher vermochte, wurde die Entwicklungszeit für neue Enzyme um den Faktor zehn verkürzt. Die Biologie wird damit endgültig zum „Software-Stack“, bei dem Design-Build-Test-Learn-Zyklen in digitalisierten Bio-Gießereien automatisiert ablaufen.

Jenseits der Petrischale: Die Treiber der Bio-Ökonomie

Drei spezifische Sub-Sektoren dominieren in diesem Jahr die Agenda der Investor*innen. An erster Stelle steht die zellfreie Biosynthese, bei der komplexe Moleküle ohne den Einsatz lebender Zellen produziert werden, was die Skalierbarkeit massiv erhöht. Pioniere wie das US-Unternehmen Solugen haben hier den Weg geebnet, doch deutsche Akteure ziehen in der Effizienz der Bioreaktor-Steuerung nach. Ein zweiter massiver Treiber ist das Microbial Carbon Upcycling: Mikroben werden so programmiert, dass sie industrielles CO2 direkt in hochwertige Proteine oder Kunststoffe umwandeln. Hier verschmelzen Klimaschutz und Produktion zu einer Einheit. Drittens sehen wir den Siegeszug der Biomanufaktur bei Alternativmaterialien – sei es durch Biomasse-Fermentation für Lederersatz aus Myzel oder durch echte Präzisionsfermentation, bei der etablierte Akteure wie die bayrische AMSilk zeigen, dass programmierte Spinnenseide-Proteine bereits in Serie gehen können. Die Lieferkette der Mode- und Automobilindustrie wird durch diese Biopolymere radikal dekarbonisiert.

Die harten Lektionen der Skalierung

Der Weg zum Erfolg war jedoch von schmerzhaften Rückschlägen gepflastert. Der prominente Crash des einstigen Branchenlieblings Amyris im Jahr 2023 wirkt bis heute als warnendes Beispiel nach. Das Unternehmen scheiterte trotz Milliardenbewertung an der Komplexität der vertikalen Integration und dem Versuch, gleichzeitig Technologieplattform und B2C-Marke zu sein. Für heutige Gründer*innen haben sich daraus vier fatale Fallstricke herauskristallisiert, die über Sieg oder Niederlage entscheiden. Erstens: Die Ignoranz gegenüber den Unit Economics. Ein Produkt, das im 5-Liter-Maßstab funktioniert, muss im 50.000-Liter-Kessel nicht zwangsläufig profitabel sein. Zweitens: Das „Regulatorik-Vakuum“. Wer die EU-Novel-Food-Verordnungen oder GVO-Richtlinien nicht von Tag eins an in die Produktentwicklung einplant, riskiert Jahre des Stillstands. Drittens: Die Fokussierung auf den Endkonsument*innen statt auf B2B-Integration. Der wahre Hebel liegt in der Lizenzierung von Prozessen an die Industrie. Viertens: Die Unterschätzung der Hardware-Komponente. SynBio ist kein reines Software-Business; ohne Zugang zu physischer Infrastruktur bleibt jede Innovation im Labor gefangen.

Deutschlands Bio-Cluster

Deutschland hat sich im internationalen Vergleich als einer der stärksten Hubs für SynBio etabliert, getrieben durch eine einzigartige Verzahnung von Spitzenforschung und industrieller Basis. In München und dem angeschlossenen IZB Martinsried konzentriert sich die größte Dichte an Venture Capital und Talenten, eng flankiert durch die Exzellenz-Cluster der TU München. Berlin hat sich durch spezialisierte Inkubatoren wie den ProVeg Incubator, Atlantic Food Labs (FoodLabs) und den Science Park Berlin-Buch zum absoluten Zentrum für FoodTech und zelluläre Landwirtschaft entwickelt. Ein weiterer Hotspot ist das Rhein-Neckar-Delta rund um Heidelberg, wo das European Molecular Biology Laboratory (EMBL) und der BioRN-Cluster eine Brücke zwischen Grundlagenforschung und Marktreife schlagen. Aachen punktet mit der RWTH und einer starken Fokussierung auf Bio-Verfahrenstechnik, während der Raum Darmstadt/Frankfurt durch die Nähe zu Giganten wie Merck und die TU Darmstadt als Kraftzentrum für die industrielle Bioproduktion gilt.

Investor*innen-Radar

Die Finanzierungslandschaft hat sich spezialisiert. Wir unterscheiden im Jahr 2026 vier Ebenen der Kapitalgeber*innen. Die spezialisierten VCs wie Forbion, BlueYard Capital oder Sofinnova Partners bringen das notwendige tiefe Domänenwissen mit. Auf der zweiten Ebene stehen Top-Tier Generalisten wie HV Capital und Earlybird, die SynBio zunehmend als Teil ihrer Dekarbonisierungs-Strategie begreifen. Besonders kritisch für die Skalierung sind die Corporate VCs der Industrie, allen voran BASF Venture Capital und Evonik Venture Capital, die nicht nur Geld, sondern auch Abnahmegarantien und technisches Know-how bieten. In der Frühphase bewegen zudem spezialisierte Mikro-Fonds wie Nucleus Capital oder erfahrene ClimateTech-Angels den Markt, oft organisiert in Syndikaten, die das „Valley of Death“ zwischen Labor und Prototyp überbrücken

Die Top-Start-ups: Unsere Must-Watch-Liste 2026

Für die folgende Auswahl der Start-ups haben wir Unternehmen analysiert, die nach 2019 in Deutschland gegründet wurden. Die Auswahlkriterien basieren auf der technologischen Tiefe (IP-Portfolio), dem Reifegrad der Pilotierung, der Validierung durch renommierte Investoren sowie dem Potenzial, bestehende industrielle Lieferketten systemisch zu verändern. Diversität in Gründungsteams und die Skalierbarkeit der zugrunde liegenden Bio-Plattform waren weitere entscheidende Faktoren.

- Cambrium (Berlin, gegründet 2020): Das Team um Dr. Mitchell Duffy nutzt eine KI-gestützte Designplattform, um neuartige Proteine mit molekularen Funktionen zu entwickeln, die in der Natur so nicht vorkommen. Ihr Fokus liegt auf der Kosmetik- und Textilindustrie, wo sie petrochemische Inhaltsstoffe durch bio-designte Alternativen ersetzen. Mit massiven Finanzierungsrunden, angeführt von Tech-Schwergewichten wie Essential Capital und dem Google-KI-Fonds Gradient Ventures, gilt Cambrium als Leuchtturm für eine neue Generation von Biomaterial-Zulieferern, die aus digitalem Code physische Hochleistungsprodukte erschaffen.

- Bluu Seafood (Berlin, gegründet 2020): Gegründet von Dr. Sebastian Rakers und Simon Fabich, ist Bluu einer der führenden europäischen Akteure im Bereich kultivierter Fisch. Durch die Kultivierung echter Fischzellen im Bioreaktor adressieren sie die Überfischung der Meere. Nach signifikanten Investments durch Lead-Investor Sparkfood sowie LBBW VC und Delivery Hero Ventures steht das Unternehmen kurz vor der ersten Marktzulassung in Singapur und den USA.

- Colipi (Hamburg, gegründet 2022): Das Spin-off der TU Hamburg, geführt von Maximilian Webers, nutzt eine patentierte Gasfermentationstechnologie, um CO2 in nachhaltige Öle und Lipide umzuwandeln. Der USP von Colipi ist die Nutzung von industriellen Abgasströmen als Rohstoff, was die Produktion extrem kosteneffizient macht. Sie konnten sich frühzeitig die Unterstützung von Top-Investoren wie dem High-Tech Gründerfonds (HTGF) und dem Innovationsstarter Fonds Hamburg sichern.

- Kynda (Jelmstorf, gegründet 2019): Ursprünglich als Keen 4 Greens von Daniel MacGowan-von Holstein und Franziskus Schnabel gegründet, bietet Kynda Plug-and-Play-Fermentationssysteme für die Lebensmittelindustrie an. Als B2B-Technologiepartner stellen sie modulare Bioreaktoren und Pilzkulturen bereit, mit denen Hersteller ihre eigenen Produktionsabfälle direkt vor Ort kostengünstig in Mykoproteine umwandeln können. Eine kürzliche 3-Millionen-Euro-Seed-Finanzierung – angeführt vom VC EnjoyVenture und massiv flankiert durch ein strategisches Investment des Geflügel-Giganten PHW-Gruppe – unterstreicht das enorme Skalierungspotenzial dieses Kreislauf-Modells.

- Nosh.bio (Berlin, gegründet 2022): Das Team um Tim Fronzek nutzt Pilzbiomasse als funktionalen Inhaltsstoff für die Lebensmittelindustrie, um Clean-Label-Produkte ohne Zusatzstoffe zu ermöglichen. Der technologische Vorsprung von Nosh.bio liegt in der Geschwindigkeit des Fermentationsprozesses. Frühphasen-Finanzierungen durch Earlybird unterstreichen das hohe Vertrauen in das Skalierungspotenzial.

- Ucaneo (Berlin, gegründet 2022): Das Team um Florian Tiller und Carla Glassl beweist, dass Synthetische Biologie auch beim Direct Air Capture (DAC) den Unterschied macht. Statt energieintensiver chemischer Filter nutzt Ucaneo eine biomimetische Technologie: Sie setzen das Enzym Carboanhydrase ein – eines der schnellsten Enzyme der Natur –, um CO2 bei Raumtemperatur direkt aus der Umgebungsluft zu binden. Mit starken Frühphasen-Finanzierungen durch DeepTech-Fonds wie Nucleus Capital und der US-amerikanischen Grantham Foundation baut Ucaneo derzeit in Berlin-Marienfelde ihre erste industrielle Testanlage auf.

- Insempra (München, gegründet 2021): Das Team um Gründer Jens Klein hat sich zum Ziel gesetzt, die massive Abhängigkeit der globalen Lieferketten von der Petrochemie zu beenden. Über ihre B2B-Technologieplattform nutzen sie Präzisionsfermentation, um maßgeschneiderte Inhaltsstoffe für die Kosmetik-, Lebensmittel- und Textilbranche quasi zu programmieren – von bio-basierten Lipiden und Aromen bis hin zu neuartigen Proteinfasern. Eine hochkarätige Finanzierungsrunde, angeführt von europäischen DeepTech-Schwergewichten wie EQT Ventures und BlueYard Capital, unterstreicht den Anspruch von Insempra, ein globaler industrieller Zulieferer der nächsten Generation zu werden.

Ausblick & Fazit: Der globale Wettlauf

Der Blick über den Tellerrand zeigt: Wir stehen in einem globalen Systemwettbewerb. In den USA treibt die per Executive Order erlassene „National Biotechnology and Biomanufacturing Initiative“ Milliardeninvestitionen in die heimische Infrastruktur, flankiert von Pionieren, die dort und in Frankreich (wie Biomemory) bereits an der Verschmelzung von SynBio und DNA-Datenspeicherung arbeiten. In Asien, insbesondere in China und Singapur, werden derweil regulatorische Hürden in Rekordzeit abgebaut, um die Marktführerschaft bei der Biomanufaktur zu übernehmen. Flankiert wird dies von Hubs wie Israel, die mit massivem VC-Kapital den globalen Markt für kultivierte Proteine dominieren wollen.

Das Fazit für das Jahr 2026: Biologie ist die Infrastruktur der Zukunft. Für Gründer*innen bedeutet dies, dass die Zeit der reinen Plattform-Versprechen vorbei ist; gefragt sind konkrete Produkte und belastbare Unit Economics. Für Investor*innen bietet SynBio die seltene Chance, echte „Impact-Rendite“ zu erzielen, indem sie Industrien transformieren, die über Jahrzehnte festgefahren waren. Wer heute den Code der Natur versteht und skalieren kann, wird die Welt von morgen nicht nur verstehen, sondern neu bauen.

Gründer*in der Woche: Brotrausch – Premium-Teig im recycelten Messbecher

Backen ohne Frust: Wie Brotrausch mit smarten Premium-Mischungen im recycelbaren Messbecher den hart umkämpften DIY-Brotmarkt aufmischen will.

Hinter der 2022 ins Leben gerufenen Marke Brotrausch, die 2023 offiziell an den Start ging, steht heute die Bremer Brot GmbH. Das Unternehmen hat die Marke im Jahr 2025 durch einen Asset Deal übernommen. An der Spitze des Start-ups steht ein Gründer, dessen Wurzeln weit abseits des klassischen Bäckerhandwerks liegen. Philipp Herrnberger, einst in der Sportvermarktung bei Werder Bremen tätig, gründete nicht aus einer entspannten Laune heraus, sondern aus gesundheitlichen Gründen. Nach dem Konsum von herkömmlichem Industrie-Brot kämpfte er immer wieder mit Beschwerden. Sein Antrieb: Ein bekömmliches, transparentes Brot ohne Zusatzstoffe zu kreieren, das man ohne Vorwissen einfach selbst backen kann.

Der Sprung aus der Agenturwelt in die Food-Szene war unkonventionell, doch genau das habe dem Team geholfen, „Dinge anders zu denken“, erinnert sich Herrnberger. In der ersten Phase finanzierte sich das anfänglich fünfköpfige Gesellschafterteam komplett aus eigenen Mitteln. Der Mix aus Bäckermeister, Kaufmann und Kreativen brachte dabei entscheidende Vorteile: „Wir konnten uns voll auf Produkt und Marke konzentrieren, ohne von Anfang an von externen Erwartungen getrieben zu sein“, erklärt der Geschäftsführer. Dennoch räumt er rückblickend offen ein, dass der Bootstrapping-Ansatz an seine Grenzen stieß. „Unter dem Strich muss man sagen, dass wir es ohne externe Investoren nicht geschafft haben“, resümiert Herrnberger über den rettenden Asset-Deal und Neustart im Sommer 2025.

Premium-Teig im recycelten Messbecher

Das Geschäftsmodell hebt sich bewusst vom preissensiblen Massenmarkt ab und richtet sich an all jene, denen im Post-Corona-Alltag schlichtweg die Zeit für aufwändige Sauerteig-Experimente fehlt. Hier setzt das Start-up mit absoluter Convenience an: Die neun natürlichen Brotmischungen erfordern laut Hersteller keinerlei Backerfahrung, kommen gänzlich ohne Küchenmaschine aus und beschränken sich auf rund zehn Minuten aktive Arbeitszeit. Die Zutaten für die „Made in Germany“-Strategie stammen aus kontrolliertem, regionalem Anbau.

Raffiniert und praktisch zugleich ist die Verpackungslösung: Die Mischungen ruhen in einem PET-Becher, der direkt als exakter Messbecher für die benötigte Wasserzugabe dient. Doch gerade ein Plastikbecher weckt in der nachhaltigkeitsgetriebenen Zielgruppe oft Skepsis. Herrnberger verteidigt die Entscheidung leidenschaftlich und verweist auf das rigorose Ausschlussverfahren in der Produktentwicklung. „Kraftpapiertüten sehen offensichtlich nachhaltig aus, wenn sie aber wie für uns beschichtet wären, können sie nur noch verbrannt werden“, kontert der Gründer. Dies sei überhaupt nicht im Sinne der Ressourcenschonung. Stattdessen setzt Brotrausch auf einen vollständig aus recyceltem PET bestehenden Becher einer deutschen Firma. Da die Pappbanderole raffiniert „einschnappt“ und nicht geklebt wird, seien beide Komponenten zu 100 Prozent wiederrecycelbar. Damit sei die Marke auch fit für zukünftige rechtliche Verpackungsvorschriften.

Smarte Nischen und margenstarkes Upselling

Anstatt den oft verlustreichen Preiskampf im regulären Supermarktregal zu suchen, etabliert sich Brotrausch konsequent als D2C-Marke im Premium-Segment. Eine reguläre Brotbackmischung schlägt mit 5,99 Euro zu Buche – eine echte Ansage für ein Produkt, in das die Kundschaft noch Strom, Wasser und Arbeitszeit investieren muss.

„Auf den ersten Blick wirkt der Preis natürlich hoch, vor allem, wenn man ihn rein mit Mehl vergleicht“, gibt Herrnberger zu bedenken. Dieser Vergleich greife jedoch zu kurz. „Wir verkaufen kein Rohprodukt, sondern ein durchdachtes Gesamterlebnis“, betont er und verweist auf die raffinierten Rezepturen und Prozesse, die zu einem Resultat führen, „das viele so zuhause sonst nicht hinbekommen würden“. Die Preisakzeptanz misst das Unternehmen primär über das Feedback und das Kaufverhalten. Als Kund*innen begannen, nicht nur ein zweites Mal zu bestellen, sondern direkt größere Pakete und mehrere Sorten in den Warenkorb legten, wusste das Team: Der Markt akzeptiert den Premium-Aufschlag. Zudem stellt Herrnberger klar: „Im Übrigen kostet das Backen im heimischen und relativ neuen Backofen keine 25 Cent.“

Aus den regulären Supermärkten hat sich Brotrausch mittlerweile bewusst zurückgezogen, da der Kampf um die Regale dort stark über den Preis diktiert wird. „Wir fokussieren uns nun auf Genusspartner wie Weinhändler, Hofläden oder Feinkosthändler, bei denen die Preise hochwertiger Produkte eher akzeptiert werden“, erklärt der Geschäftsführer den strategischen Kurswechsel.

Um die ambitionierte Preisgestaltung zu rechtfertigen, inszeniert das Start-up seine Produkte gezielt als Lifestyle-Upgrade – etwa für das autarke Vanlife beim Camping, als Mitbringsel zum Grillen oder für den Osterbrunch. Flankiert wird das Kernsortiment durch ein lukratives Upselling-Portfolio, das von stilvollen Geschenkboxen für knapp 30 Euro bis hin zu speziellen Baguette-Backblechen, Fruchtaufstrichen und Stullensalzen reicht. Diese Zusatzartikel seien laut Herrnberger zwar nicht essenziell für das Überleben des Unternehmens, da das Brotbacken der Mittelpunkt bleibe, sie seien aber entscheidend für das Wachstum. „Im E-Commerce geht es um den durchschnittlichen Warenkorb und die Retention“, analysiert der Gründer. Das Zusatzsortiment mache das „Erlebnis Brot“ noch intensiver. Der Umsatzanteil dieser lukrativen Extras liegt aktuell bei knapp 15 Prozent.

Die Gretchenfrage der Kund*innenbindung

Dieser strategische Ansatz sichert gesunde Margen und entzieht die Marke geschickt der Vergleichbarkeit mit Discountern. Dennoch bleibt eine große Herausforderung: Der Markt für DIY-Lebensmittel ist durch starke Bio-Traditionsmarken massiv umkämpft. Die größte Hürde besteht darin, die Wiederkaufsrate auf einem profitablen Niveau zu halten. Denn wenn die stylische Mischung primär als originelles Präsent zum Vatertag verschenkt wird, fehlen dem Unternehmen am Ende die wiederkehrenden Alltagsumsätze.

Einen aggressiven Rollout in den stationären Einzelhandel schließt Herrnberger vorerst aus. Dies sei nur mit hohen Investitionen machbar und berge das Risiko, zu einem „One-Hit-Wonder“ zu verkommen. Die Devise lautet stattdessen: „Wir wollen gesund wachsen, um profitabel zu werden.“ Die Geschenkboxen spielen in dieser Strategie eine überraschende Doppelrolle. Sie treffen nicht nur den Zeitgeist, sondern fungieren als cleverer Akquise-Kanal. „Wir erreichen dadurch Menschen, die uns vielleicht noch nicht kennen und unmittelbar mit der Marke, der Qualität und dem Erlebnis in Berührung kommen“, freut sich Herrnberger. Auf diese Weise spare man sich enorme Kund*innenakquisitionskosten. Zudem entwickle sich das Geschenke-Segment zunehmend zu einem echten Profitcenter im B2B-Bereich – etwa wenn Immobilienmakler die Boxen zur Hausübergabe als modernes „Brot und Salz“-Präsent nutzen.

Trotz der starken Nischen-Performance ist klar: Brotrausch muss langfristig beweisen, dass das Premium-Brot aus dem Becher nicht nur an Feiertagen verschenkt wird, sondern den dauerhaften Sprung in die alltägliche Frühstücksroutine der Konsument*innen schafft.

Gründer*in der Woche: SIRPLUS – Überlebenskampf im Food-Outlet-Markt

Während der millionenschwere Rivale Motatos aus Deutschland flieht, schreibt ein einstiger Sanierungsfall plötzlich schwarze Zahlen. Wie unser(e) Gründer*in der Woche – das Berliner Social Business SIRPLUS von Raphael Fellmer – vom gehypten Start-up zum krisenerprobten Mittelständler reifte.

Das Berliner Social Business SIRPLUS hat bewegte Jahre hinter sich. Nach einer überstandenen Insolvenz 2024 erfindet sich das ehemalige Vorzeige-Start-up um Gründer Raphael Fellmer aktuell neu – und setzt auf Community statt auf klassisches VC-Kapital. Mitten in diese Konsolidierungsphase platzt im April 2026 der Deutschland-Rückzug des Konkurrenten Motatos. Ein Lehrstück über die harten Grenzen des Skalierens und den schmerzhaften Weg vom gehypten Start-up zum krisenerprobten Mittelständler.

Paradoxon im Food-Markt: Der Sanierungsfall überlebt den Giganten

Es ist eine Nachricht, die in der hiesigen FoodTech-Szene aktuell für ein mittelschweres Beben sorgt: Der schwedische Online-Discounter Motatos zieht sich aus Deutschland zurück. Trotz rund 300.000 aktiven Kund*innen und einem beachtlichen Jahresumsatz von über 35 Millionen Euro zieht das Unternehmen Mitte April 2026 die Reißleine. Das Deutschland-Geschäft blieb hochgradig defizitär. Die Begründung: Man wolle sich auf das profitable Wachstum in den nordischen Heimatmärkten konzentrieren. Dieser Rückzug wirft ein grelles Licht auf die strukturellen Herausforderungen des deutschen Lebensmittelmarkts. Doch während der finanzstarke Konkurrent aus dem Norden kapituliert, hält ausgerechnet das Berliner Unternehmen SIRPLUS die Stellung – ein Turnaround-Case, der erst vor Kurzem selbst am Abgrund stand.

Warum überlebt SIRPLUS dort, wo ein millionenschwerer Riese aufgibt? Gründer Raphael Fellmer macht sich keine Illusionen über das Marktumfeld. „Wir haben in Deutschland wohl einen der härtesten umkämpften Lebensmittelmärkte in der EU“, analysiert er die Lage. Dass nach dem US-Giganten Walmart nun mit Motatos der nächste Konzern den Rückzug antrete, sei bezeichnend. Die eigene Überlebensstrategie liege in den Lehren der bitteren Vergangenheit. „Wir haben bei SIRPLUS 2.0 einen so radikalen Pivot hingelegt, wie ich es nicht für möglich gehalten hätte“, betont der Gründer. Das Erfolgsrezept liege heute nicht mehr in der reinen Größe, sondern in extremer Agilität und einem strikten Fokus auf organisches Wachstum. Die Rechnung scheint aufzugehen: Auch wenn die Berliner rund 20-mal weniger Umsatz machen als der scheidende Konkurrent Motatos, schreiben sie laut Fellmer bereits schwarze Zahlen. Für 2026 kündigt er erstmals seit der Gründung mehr Einnahmen als Ausgaben an.

„Das entlastet mich persönlich sehr, weil ich seit Jahren im Dauerfunding-Modus bin.“

Raphael Fellmer über die ersten schwarzen Zahlen seit der Gründung 2017

„Wir sind nicht per Du“: Wenn Purpose auf Realität prallt

Die Geschichte von SIRPLUS ist untrennbar mit seinem prominenten Gründer verbunden. Der Klimaaktivist erlangte Bekanntheit, weil er aus Protest gegen die Wegwerfgesellschaft fünfeinhalb Jahre lang komplett ohne Geld lebte und sich durch „Containern“ ernährte. Nach dem Aufbau der Foodsharing-Initiative folgte 2017 gemeinsam mit Martin Schott die Gründung von SIRPLUS. Das Kern-Geschäftsmodell: Das Unternehmen rettet bei Produzent*innen und Großhändler*innen überschüssige Ware – etwa wegen nahendem Mindesthaltbarkeitsdatum (MHD), Überproduktionen oder Verpackungsfehlern – und verkauft diese D2C (Direct-to-Consumer) über den eigenen Online-Shop mit Rabatt an Endkund*innen.

Damals griff das Team mit diesem Konzept nach den Sternen des klassischen Start-up-Wachstums. Doch der Spagat zwischen Weltverbesserung und knallhart skalierbarem E-Commerce erwies sich als tückisch. Das zeigte sich eindrücklich im September 2019 bei einem denkwürdigen Auftritt in der TV-Show Die Höhle der Löwen. Fellmer und Schott forderten 700.000 Euro für 6 Prozent der Anteile – was einer überaus ambitionierten Firmenbewertung von fast 11,7 Millionen Euro entsprach.

Die Kombination aus Social-Impact-Rhetorik und massiver kapitalistischer Bewertung sorgte für einen beispiellosen Eklat. Investor Georg Kofler warf dem Duo „moralisierendes Schöngerede“ vor. Als die Gründer sich rechtfertigen wollten und Kofler dabei duzten, unterbrach dieser scharf mit einem Satz, der in die deutsche TV-Geschichte einging: „Wir sind nicht per Du. Unter Multimillionären ist man eine Weile per Sie.“ Das Team verließ das Studio ohne Deal. Die Investoren hatten den wunden Punkt getroffen: Ein gesellschaftliches Problem moralisch aufzuladen, heilt keine schwachen Unit Economics.

Rückblickend gibt sich Fellmer geläutert, verhehlt aber auch seine damalige Verletztheit nicht. Die Einladung zur Show habe man primär angenommen, um Reichweite für das Thema Lebensmittelverschwendung zu generieren. „Dass wir so stark kritisiert und vor allem auch persönlich angegriffen würden, hätte ich mir nicht vorstellen können“, gibt er unumwunden zu. Die völlig überzogene Firmenbewertung rechnet er heute der eigenen Naivität an: „Wir kannten uns nicht aus und waren glücklich darüber – ohne zu verstehen, dass eine zu hohe Bewertung auch hinderlich sein kann.“

Der harte Cut: Vom 90-Köpfe-Team zum Sanierungsfall

Die Kritik der Löwen sollte sich in gewisser Weise als prophetisch erweisen. Das Geschäftsmodell erfordert es, schwere, niedrigpreisige Güter aufwendig zu lagern, zu kommissionieren und per Paketdienst zu verschicken. Die Logistikkosten fraßen die Margen auf. Als Ende 2023 im ohnehin schwierigen Marktumfeld eine rettende Finanzierungsrunde platzte, musste SIRPLUS im Januar 2024 Insolvenz anmelden. Und das, obwohl das Team von ehemals rund 90 auf unter 30 Mitarbeitende Monate vor der Pleite radikal eingedampft wurde. Die verlustreichen stationären „Rettermärkte“ gehörten schon zwei Jahre zuvor der Vergangenheit an. Im Mai 2024 gelang zwar die Rettung durch drei Viertel der Bestandsinvestor*innen, doch der Preis war hoch: Aus dem einstigen Hyper-Wachstums-Narrativ wurde ein harter Überlebenskampf. SIRPLUS wurde zeitweise vom gehypten Start-up zum Sanierungsfall.

„Es war sehr hart, nach sieben Jahren Kampf anzuerkennen, dass wir es einfach nicht geschafft haben, wirtschaftlich zu werden.“

Raphael Fellmer über den Tiefpunkt vor dem Neustart

Der personelle Aderlass ging an die Substanz. Zwischenzeitlich kämpfte der Gründer praktisch allein, mit seinem Bruder als einzigem Mitarbeiter. Dennoch sei sein Wille ungebrochen gewesen. Den operativen Neustart nach der Pleite diktierte der Rotstift: „Leane Struktur ohne Obst und Gemüse, keine bezahlte Werbung, sondern organisches Wachstum, kein Büro, sondern Remote-Only“, summiert Fellmer die harten Schnitte. Statt teurer Bezahldeals stütze man sich heute auf langfristige Partnerschaften.

Der radikale Pivot: Community statt teurer Klicks

Aktuell ist SIRPLUS Teil der neuen YouTube-Show The Green Deal, ein Format, das gezielt die Abkehr vom rein kapitalgetriebenen Skalieren propagiert. Der neue Hebel für SIRPLUS: Reichweite, Community-Building und Creator-Beteiligungen. Die betriebswirtschaftliche Logik dahinter ist zwingend: Wenn hohe Customer Acquisition Costs (CAC) im klassischen Performance-Marketing das ohnehin margenschwache Modell ruinieren, muss die Kundenakquise organisch erfolgen. Durch die enge Bindung an Influencer und eine wertegetriebene Community sollen treue Käufer*innenschichten aufgebaut werden.

Dass dieses Konzept mehr als nur eine Notlösung für fehlendes VC-Geld ist, belegen harte Zahlen. Fellmer beziffert die aktuellen Customer Acquisition Costs stolz auf „unter 5 Euro“. Dieser Wert sei sieben- bis zehnmal besser als noch zu Zeiten von SIRPLUS 1.0. Auf klassische Bezahlkooperationen verzichtet das Start-up mittlerweile völlig; man vergütet rein über Umsatzbeteiligungen oder gespendete Schulmahlzeiten. „Wir suchen weiter nach authentischen Partnerschaften mit Menschen mit Reichweite, die sich für eine Welt einsetzen wollen, in der alle genügend zu essen haben“, skizziert Fellmer sein Anforderungsprofil an Creator. Die Strategie trägt Früchte: Von Q1 2025 auf Q1 2026 verzeichnete das Unternehmen laut Gründer ein Wachstum von 100 Prozent.

Die SIRPLUS-Formel: Drei harte Lektionen für Social Start-ups

Warum widmen wir uns bei StartingUp einem neunjährigen Unternehmen, das streng genommen längst kein Start-up mehr ist? Weil junge Gründer*innen aus exakt dieser Transformation unbezahlbare Lehren für die eigene Frühphase ziehen können:

- Purpose ersetzt keine Unit Economics: Der Fall SIRPLUS demonstriert schonungslos, dass selbst die stärkste gesellschaftliche Mission eine fehlerhafte betriebswirtschaftliche Basis (hohe Logistikkosten bei niedrigen Warenkörben) nicht dauerhaft kompensieren kann. Wer heute ein Social Start-up gründet, muss seine Margen noch rigoroser verteidigen als traditionelle E-Commerce-Modelle.

- Die Grenzen des VC-Modells erkennen: Nicht jedes Geschäftsmodell eignet sich für Venture Capital. Die Entwicklung von SIRPLUS und der aktuelle Motatos-Exit zeigen, dass der Food-Outlet-Markt extrem schwer zu skalieren ist. Junge Start-ups lernen hier, alternative Wachstumswege frühzeitig in Betracht zu ziehen, bevor sie sich in eine gefährliche VC-Abhängigkeit begeben.

- Resilienz als Kernkompetenz: Dass Raphael Fellmer das Tal der Tränen durchschritten hat und sich dem Markt nach einer Insolvenz mit angepasstem Modell neu stellt, ist ein Meisterkurs in Pivotierung und unternehmerischer Widerstandskraft.

Die Konkurrenzsituation hat sich durch den Motatos-Exit nun paradoxerweise entspannt. Ob die Gleichung „Reichweite statt Performance-Marketing“ am Ende aufgeht, wird eine der spannendsten Case Studies der aktuellen Wirtschaftsszene – und ein wertvoller Blueprint für die Start-ups von morgen.

Fellmer selbst zeigt sich für die Zukunft demütig, aber siegessicher. Auf dem Weg zur Profitabilität habe man zwar fast 10 Millionen Euro an Funding benötigt und schmerzhaftes Lehrgeld gezahlt, doch „das Dranbleiben, Neudenken und nicht Aufgeben hat sich gelohnt“. Für 2026 verspricht der Gründer erstmals ein nachhaltig profitables Gesamtjahr. Neben der rein wirtschaftlichen Stabilität hat der passionierte Kämpfer gegen Food Waste inzwischen aber auch einen „ganz profanen“ Meilenstein im Visier: „Für mich persönlich ist dieses Jahr ein echter mehrwöchiger Urlaub nach 14 Jahren des Fast-Durch-Arbeitens ein wichtiges Ziel.“

Wie das TechBio-Start-up mbiomics mit 30 Mio. Euro die Krebstherapie skalierbar machen will

Stuhltransplantationen haben gezeigt, dass das Darmmikrobiom ein mächtiger Hebel gegen Krebs sein kann – doch der Ansatz ist bisher kaum standardisierbar. Das Münchner Unternehmen mbiomics setzt auf künstliche Intelligenz und maßgeschneiderte Bakterien-Cocktails aus dem Labor. Mit dem Abschluss einer 30-Millionen-Euro-Serie-A-Runde rückt die klinische Phase näher. Ein genauer Blick auf das Geschäftsmodell, die Gründer*innen und einen hart umkämpften globalen Markt.

Wer heute von modernster Krebstherapie spricht, kommt am menschlichen Darm nicht mehr vorbei. Die wissenschaftliche Datenlage der letzten Jahre hat sich massiv verdichtet: Ob ein Patient auf revolutionäre Krebs-Immuntherapien (wie Immun-Checkpoint-Inhibitoren) anspricht, hängt maßgeblich von der individuellen Zusammensetzung seines Mikrobioms ab. Das Münchner TechBio-Unternehmen mbiomics hat sich genau dieses Zusammenspiel zur Mission gemacht und gab heute den dritten Abschluss seiner Serie-A-Finanzierungsrunde bekannt. Mit neu eingeworbenen 12 Millionen Euro wächst das Gesamtvolumen der Runde auf beachtliche 30 Millionen Euro.

Das Kapital, das unter anderem von erfahrenen Investoren wie den MIG Fonds und Bayern Kapital stammt, markiert für das 2020 gegründete Unternehmen einen entscheidenden Wendepunkt: den Übergang von der reinen Technologieplattform hin zur klinischen Anwendung am Menschen. Der führende Wirkstoffkandidat „MBX-116“ soll 2027 in einer Phase-1B-Studie an Patienten mit fortgeschrittenem schwarzen Hautkrebs (Melanom) getestet werden. Doch wie belastbar ist dieser Ansatz im Vergleich zum Wettbewerb?

Die Köpfe hinter der Vision

Aus der Taufe gehoben wurde mbiomics im Jahr 2020 von Dr. Laura Figulla, Dr. Johannes B. Wöhrstein und Dr. Markus Rinecker. Während die Mitgründer Figulla und Rinecker das Unternehmen in der frühen Phase prägten, wird die nun anstehende Skalierung und klinische Validierung von einem spezialisierten Leadership-Trio gesteuert:

- Dr. Johannes B. Wöhrstein (CEO & Mitgründer): Als technologischer Kopf und Geschäftsführer verantwortet er die firmeneigene Plattform. Seine Expertise in hochauflösender Analytik ist das Fundament, um komplexe mikrobielle Netzwerke mithilfe von maschinellem Lernen (KI/ML) überhaupt erst zu kartieren.

-

Kristin Torre Vinuesa (CFO): Als Chief Financial Officer verantwortet sie die finanziellen Geschicke des Unternehmens. Ihre Rolle ist entscheidend, um die neu eingeworbenen 30 Millionen Euro strategisch einzusetzen, den naturgemäß hohen Kapitalbedarf der anstehenden klinischen Studien („Cash Burn“) effizient zu steuern und das finanzielle Fundament für zukünftige Runden zu sichern.

- Dr. Christopher Weidenmaier (CSO): Der erfahrene Mikrobiologe (zuvor unter anderem beim US-Konkurrenten Finch Therapeutics) komplettiert das heutige Führungstrio. Als Chief Scientific Officer leitet er die präklinische Forschung und treibt das rationale Design der komplexen Bakterien-Konsortien maßgeblich voran.

Das Problem: Die Unberechenbarkeit der Natur

Um das Geschäftsmodell zu verstehen, muss man den Status quo betrachten. In der Onkologie wird aktuell intensiv mit Stuhltransplantationen (Fecal Microbiota Transplants, FMT) experimentiert. Dabei wird das Mikrobiom von Patient*innen, die hervorragend auf Krebsmedikamente ansprechen, auf „Non-Responder“ übertragen. Die Erfolge sind bemerkenswert, doch das Verfahren hat einen massiven Haken: Stuhl ist ein hochvariables Naturprodukt. Er ist schwer zu standardisieren, birgt Infektionsrisiken und lässt sich nicht als skalierbares Pharma-Produkt im industriellen Maßstab herstellen.

Hier setzt mbiomics mit sogenannten Live Biotherapeutic Products (LBPs) an. Statt auf ungefilterte Spender*innen-Transplantate zu setzen, identifiziert das Team mittels KI genau jene Bakterienstämme, die für den therapeutischen Effekt verantwortlich sind. Diese werden dann im Labor nach pharmazeutischen GMP-Standards gezüchtet und als orale Kapsel verabreicht. Es ist der Versuch, die „Blackbox“ Darm in ein berechenbares, patentierbares Medikament zu verwandeln.

Wo liegen die Risiken?

Für Beobachter*innen der Start-up-Szene bleibt das Vorhaben trotz der Millionen-Finanzierung eine Hochrisiko-Wette. Ein TechBio-Start-up in diesem Stadium hat einen enormen „Cash Burn“. Die 30 Millionen Euro sind ein starkes Fundament, doch die klinische Entwicklung in der Onkologie ist ein Langstreckenlauf, der oft dreistellige Millionenbeträge verschlingt.

Zudem ist das Geschäftsmodell hochgradig binär: Die für 2027 geplante Studie muss erst beweisen, dass die im Labor designten Bakterien-Konsortien im komplexen menschlichen Ökosystem tatsächlich die erhoffte Wirkung zeigen. Ein Scheitern des Leitkandidaten MBX-116 könnte das gesamte Vertrauen in die Plattform erschüttern. Zudem ist die Herstellung lebender Bakterien in absolut reproduzierbarer Qualität eine enorme logistische und biotechnologische Herausforderung, an der bereits andere Pioniere der Branche hängen geblieben sind.

Der Markt: Ein globales Rennen

Mbiomics ist nicht allein auf diesem Feld. Das Unternehmen muss sich gegen hochkapitalisierte internationale Konkurrent*innen behaupten:

- MaaT Pharma (Frankreich): Die Franzosen sind klinisch bereits weiter fortgeschritten und setzen auf „Full-Ecosystem“-Produkte aus gepoolten Spenderproben. Mbiomics muss beweisen, dass ihr synthetischer Präzisions-Ansatz dem natürlichen Mix überlegen ist.

- Vedanta Biosciences (USA): Ein US-Schwergewicht, das ebenfalls definierte Bakterienkonsortien entwickelt und bereits über ein breites Netzwerk an Kooperationen mit der Big-Pharma-Industrie verfügt.

Unsere Einordnung

Für das deutsche Ökosystem ist der Erfolg von mbiomics ein Leuchtturm-Signal. Dass Investoren wie MIG – die bereits bei BioNTech ein frühes Gespür bewiesen – hier massiv nachlegen, unterstreicht die Qualität des Standorts München.

Mbiomics wählt den schwierigen, aber potenziell nachhaltigeren Weg. Statt auf die bloße Kopie der Natur zu setzen, versucht das Team, das Mikrobiom durch Daten beherrschbar zu machen. Gelingt der klinische Wirksamkeitsnachweis ab 2027, könnte das Start-up nicht nur die Onkologie verändern, sondern auch Blaupausen für die Behandlung von Autoimmun- und neurodegenerativen Erkrankungen liefern. Der Weg bis dahin bleibt jedoch teuer und wissenschaftlich riskant.

Wenn das Team zum Flaschenhals wird: Warum Start-ups oft an „Ghost Positions“ scheitern

Schnelles Wachstum birgt Risiken: Wachsen Teams nicht mit, entstehen toxische „Ghost Positions“. Ex-Tibber-Deutschland-Chefin Marion Nöldgen erläutert im Interview, wie Gründer*innen gegensteuern.

Schnelles Wachstum – die sogenannte Hypergrowth-Phase – ist das ultimative Ziel und oft die wichtigste Metrik nach einer erfolgreichen Finanzierungsrunde. Doch genau im Moment des größten Triumphs lauert eine der gefährlichsten Fallen für junge Unternehmen: Das Start-up skaliert rasant, aber die Menschen und die internen Strukturen kommen nicht mehr hinterher.

Die Folgen dieses mangelhaften „People Scalings“ werden oft viel zu spät erkannt und können das Wachstum empfindlich bremsen. Ein typisches Symptom sind sogenannte Heritage Hires: Mitarbeitende der ersten Stunde, die aus Loyalität und Historie plötzlich in große C-Level- oder VP-Rollen hineingewachsen sind, denen sie fachlich oder führungstechnisch (noch) nicht gewachsen sind. Ignoriert die Geschäftsführung dieses Problem, reagiert das System von selbst – es entstehen „Ghost Positions“. Im Schatten des offiziellen Organigramms bilden sich heimliche Parallelstrukturen, um eigentlich zuständige, aber überlastete oder überforderte Führungskräfte schlichtweg zu umgehen.

Wie Gründer*innen diese tückischen Wachstumsfallen rechtzeitig erkennen und proaktiv auflösen, weiß die Clearimpact-Gründerin Marion Nöldgen. Als Expertin für Organizational Design und zertifizierte Aufsichtsrätin kennt sie die Wachstumsschmerzen schnell skalierender Unternehmen aus erster Hand. In den vergangenen zehn Jahren hat sie als Geschäftsführerin mehrere Start-ups aufgebaut, internationalisiert und durch extreme Wachstumsphasen geführt – unter anderem die deutsche Tochter des GreenTech-Unternehmens Tibber, den bekannten Pionier für dynamische Stromtarife.

Im StartingUp-Interview erklärt sie, warum die meisten Businesspläne nicht am Markt, sondern am falschen Team-Setup scheitern, wie man schwierige Gespräche mit loyalen Mitarbeitenden der ersten Stunde führt und wie ein Organisationsdesign aussehen muss, das echtes Wachstum aushält.

Marion, du hast in den letzten zehn Jahren zahlreiche Unternehmen gegründet, internationalisiert und in absolute Hypergrowth-Phasen begleitet. Wenn du auf diese Zeit zurückblickst: Was war dein größtes Learning in Bezug auf das Team-Wachstum?

Marion Nöldgen: Dass Wachstum nicht daran scheitert, dass man zu wenig gute Leute hat – sondern daran, dass man sie nicht richtig einsetzt.

In frühen Phasen funktioniert viel über Intuition, Vertrauen und Geschwindigkeit. Das trägt einen ziemlich weit. Aber irgendwann kippt das System. Rollen werden größer, Anforderungen komplexer – und plötzlich reicht es nicht mehr, dass jemand „gut ist“. Er oder sie muss auch schnell genug mit einer Rolle mitgewachsen sein.

Gleichzeitig verändert sich die Struktur selbst. Was am Anfang gebraucht wurde, gibt es in dieser Form später oft gar nicht mehr – oder es kommen komplett neue Anforderungen dazu, für die es vorher schlicht keine Rolle gab.

Mein größtes Learning: Man muss nicht nur die richtigen Leute holen und halten, sondern auch Rollen aktiv weiterentwickeln – und beides immer wieder neu aufeinander abstimmen. Sonst wächst das Unternehmen, aber die Organisation hält nicht mit.

In deiner aktuellen These triffst du einen wunden Punkt: Du sagst, die meisten Businesspläne scheitern nicht am Markt, sondern am falschen Team. Warum wird das People Scaling – im Gegensatz zum Skalieren von Produkt oder Vertrieb – von Gründer*innen oft so stiefmütterlich behandelt?

Marion Nöldgen: Weil es deutlich unangenehmer ist.

Produkt, Vertrieb, Zahlen – das ist rational. Da kann ich Hypothesen testen, optimieren, Entscheidungen treffen. Beim Team geht es um Menschen, Beziehungen, Loyalität und offene Konflikte. Da wird es erstens schnell persönlich und zweitens dauert es oft lange, bis die Probleme überhaupt sichtbar werden. Schlechte Produktentscheidungen merkt man relativ schnell. Schlechte Teamentscheidungen oft erst Monate später – wenn Strukturen schon verhärtet sind.

Viele hoffen dann, dass es sich „einfach einspielt“. Tut es aber meistens nicht.

Lass uns über ein sehr sensibles Thema sprechen: Heritage Hires. Oft wachsen Mitarbeiter der ersten Stunde plötzlich in Führungspositionen (z.B. als VP oder Head of) hinein, für die sie eigentlich (noch) nicht bereit sind. Ab wann wird Loyalität hier zum Wachstumsrisiko für das Unternehmen?

Marion Nöldgen: In dem Moment, in dem die Rolle mehr verlangt, als die Person leisten kann – und man es trotzdem laufen lässt. Loyalität ist extrem wertvoll. Gerade in der Anfangsphase. Aber sie ist kein Ersatz für Erfahrung oder Führungsfähigkeit.

Das Risiko entsteht nicht dadurch, dass jemand noch nicht so weit ist – das ist normal. Es entsteht, wenn man weder Rolle noch Besetzung anpasst, obwohl beides längst nicht mehr zusammenpasst.

Die menschliche Komponente ist hier extrem schwierig: Wie gehe ich als Gründer*in oder CEO das Gespräch mit einem hochverdienten Heritage Hire an, wenn ich merke, dass die Rolle zu groß geworden ist, ohne diese Person zu demotivieren oder gar ans Unternehmen zu verlieren?

Marion Nöldgen: Indem man Rolle und Besetzung klar trennt – und genau so ins Gespräch einsteigt. Also nicht über die Person sprechen, sondern über die Rolle: Was muss sie aktuell liefern? Und wo stehen wir heute? Oft ist die Lücke ziemlich offensichtlich – und auch, dass sie nicht realistisch zu schließen ist. Gleichzeitig sollte klar gemacht werden: Es geht nicht darum, die Person zu verlieren. Im Gegenteil – man möchte sie halten und gemeinsam schauen, in welcher Rolle sie künftig wirklich wirksam sein kann.

Die meisten spüren das selbst längst. Was fehlt, ist die klare, ehrliche Ansprache.

Wenn das sauber gemacht wird, stehen die Chancen gut, dass die Person bleibt – nur eben in einer für sie und das Unternehmen wirksamen Rolle.

Ignoriert man das Problem der überlasteten Führungskräfte, entstehen laut dir sogenannte Ghost Positions und Parallelstrukturen. Woran erkenne ich als Geschäftsführung rechtzeitig, dass mein Team anfängt, das eigentliche Organigramm heimlich zu umgehen? Gibt es typische Red Flags?

Marion Nöldgen: Ja, ziemlich klare sogar.

Entscheidungen dauern ungewöhnlich lange – oder werden plötzlich woanders getroffen. Themen „wandern“ durch die Organisation, bis sie jemand entscheidet.

Du siehst, dass Leute sich bewusst andere Ansprechpartner suchen als die eigentlich zuständige Führungskraft. Oder dass Dinge einfach selbst gelöst werden, um voranzukommen.

Das sind alles Signale dafür, dass die formale Struktur nicht mehr mit der Realität übereinstimmt.

Wenn das Kind bereits in den Brunnen gefallen ist und sich Ghost Positions etabliert haben – wie löst man diese Schattenstrukturen wieder auf, ohne dass das operative Geschäft zusammenbricht?

Marion Nöldgen: Auf jeden Fall nicht alle auf einmal!

Der erste Schritt ist Transparenz: sichtbar machen, wie Entscheidungen aktuell tatsächlich getroffen werden. Das ist oft schon ein Augenöffner.

Dann geht es darum, Verantwortung wieder sauber zuzuordnen – und konsequent dorthin zurückzugeben. Das braucht Zeit und Kommunikation.

Und ehrlich gesagt: In manchen Fällen kommt man nicht darum herum, auch personell etwas zu verändern. Alles andere ist Kosmetik.

Als Expertin für Organizational Design: Wie muss eine Unternehmensstruktur aufgebaut sein, die einerseits flexibel genug für die typische Start-up-Agilität ist, andererseits aber stark genug, um Phasen extremen Wachstums (z.B. nach einer Series A oder B) auszuhalten?

Marion Nöldgen: Sie muss klarer sein, als viele denken – aber nicht komplizierter.

Was es braucht, sind klare Rollen, klare Entscheidungswege und ein gemeinsames Verständnis davon, wer für was verantwortlich ist.

Flexibilität entsteht nicht durch Unklarheit, sondern dadurch, dass alle wissen, wo sie sich bewegen können. Wenn das fehlt, wird jede Veränderung anstrengend.

Wie bindet man Weiterbildung und Leadership-Training in ein Umfeld ein, in dem eigentlich immer die Devise „Execution first“ gilt?

Marion Nöldgen: Indem man es auch genau so behandelt: als Teil der Arbeit – nicht als Extra. Ich bin kein großer Fan von Wochenend-Workshops oder theoretischen Trainings „on top“. Gerade in frühen Wachstumsphasen bringt das wenig.

Entscheidend ist Training on the job. Das heißt konkret: Lernen passiert im Alltag. In echten Meetings, echten Entscheidungen, echten Situationen. Genau dort kann man direkt Feedback geben – zum Beispiel, wenn ein Teammeeting unklar geführt ist oder Erwartungen nicht sauber formuliert werden.

Es geht weniger um Theorie und mehr darum, in der konkreten Arbeit besser zu werden.

Zum Abschluss: Wenn du einem Gründungsteam, das gerade ein großes Funding abgeschlossen hat und kurz davor steht, sein Team zu verdreifachen, nur einen einzigen Rat mit auf den Weg geben dürftest – welcher wäre das?

Marion Nöldgen: Schaut euch ehrlich in die Augen und fragt euch: Was müssen wir konkret liefern, um das, was wir gepitcht haben, wirklich umzusetzen? Also: Welchen Output muss jede einzelne Rolle erzeugen – nicht high level, sondern ganz konkret, was ist das Ergebnis dieser Arbeit?

Wer verantwortet welchen Teil – und kann die Person das auch leisten?

Und wenn nicht, muss man es ansprechen. Früh. Und mittelfristig wahrscheinlich etwas verändern.

Danke, Marion, für die spannenden Insights!

Das Interview führte StartingUp-Chefredakteur Hans Luthardt

Nicht nur pitchen, auch ankommen: Was ein professioneller Auftritt auf Events und Messen ausmacht

Auf Messen zählt für Start-ups mehr als nur der Pitch. Ein souveräner Auftritt gelingt erst durch Struktur, Vorbereitung und das richtige Umfeld.

Wer als junges Unternehmen auf Events, Messen oder Branchentreffen unterwegs ist, denkt oft zuerst an den eigentlichen Auftritt. Pitch, Präsentation, Gespräche am Stand, Networking oder ein Termin mit potenziellen Partnern stehen schnell im Mittelpunkt. Im Alltag zeigt sich aber, dass der professionelle Eindruck viel früher beginnt. Er entsteht nicht erst in dem Moment, in dem gesprochen wird, sondern schon in der Art, wie gut ein Termin vorbereitet ist, wie ruhig ein Tag abläuft und wie stimmig einzelne Programmpunkte ineinandergreifen.

Gerade Start-ups unterschätzen diesen Punkt leicht. In frühen Phasen wird vieles parallel organisiert. Produkt, Kommunikation, Kundentermine und operative Aufgaben laufen ohnehin gleichzeitig. Wenn dann noch ein Event oder eine Messe dazukommt, wird häufig vor allem auf Inhalte geachtet. Das greift aber zu kurz. Denn ein überzeugender Auftritt hängt nicht nur davon ab, was gesagt wird, sondern auch davon, unter welchen Bedingungen dieser Auftritt stattfindet.

Ein guter Eventtag beginnt nicht erst vor Publikum

Viele Termine außer Haus wirken von außen kompakt, sind intern aber erstaunlich dicht. Anreise, Check-in, Abstimmung im Team, Material, Gespräche vor Ort, spontane Kontakte, kurze Pausen und Nachbereitung greifen oft ineinander. Wenn diese Übergänge nicht sauber geplant sind, entsteht unnötige Reibung. Dann fehlt Konzentration genau in den Momenten, in denen ein Unternehmen besonders präsent wirken sollte.

Für Gründerteams ist das relevant, weil auf Messen und Events oft mehrere Ziele gleichzeitig verfolgt werden. Sichtbarkeit, Kundengewinnung, Netzwerke, Partnergespräche und Marktbeobachtung laufen parallel. Wer in diesem Umfeld professionell wirken will, braucht nicht nur gute Inhalte, sondern auch einen Ablauf, der Stabilität gibt.

Warum der Gesamteindruck mehr ist als Pitch und Outfit

Ein professioneller Auftritt wird oft zu eng verstanden. Viele denken dabei an Kleidung, Präsentationsmaterial oder das Gespräch selbst. Tatsächlich wirkt aber der gesamte Rahmen mit. Wer gehetzt ankommt, Unterlagen spontan zusammensucht oder zwischen Programmpunkten keine klare Struktur hat, verliert schnell Wirkung. Umgekehrt kann ein klar organisierter Tag dafür sorgen, dass auch kurze Kontakte souveräner und verbindlicher erscheinen.

Das ist gerade für Start-ups wichtig, weil sie häufig nicht mit Größe, sondern mit Klarheit, Präsenz und Verlässlichkeit punkten müssen. Auf Events zählt nicht nur der Inhalt, sondern auch das Gefühl, das ein Gespräch hinterlässt. Wirkt ein Team vorbereitet? Ist es ansprechbar, ohne hektisch zu sein? Kann es zwischen verschiedenen Terminen professionell umschalten? Solche Faktoren entscheiden mit darüber, wie ein junges Unternehmen wahrgenommen wird.

Mehrtägige Formate brauchen einen besseren Rahmen

Besonders deutlich wird das bei Messen oder Veranstaltungen, die nicht nach zwei Stunden vorbei sind. Wer über mehrere Programmpunkte, Tage oder Abendtermine hinweg präsent sein muss, braucht mehr als nur eine Anreiseoption. Dann geht es darum, wie sich ein Ablauf tragen lässt, ohne dass die Qualität des Auftritts im Laufe des Tages spürbar sinkt.

Wenn rund um Messen, Pitches oder Vor-Ort-Termine mehrere Programmpunkte zusammenkommen, kann ein modernes Hotel Nürnberg den professionellen Rahmen eines solchen Auftritts sinnvoll ergänzen. Der Mehrwert liegt dabei nicht in Übertreibung, sondern in Nutzbarkeit. Wer zwischen Terminen kurz zurückkehren, sich sortieren, Material anpassen oder den nächsten Programmpunkt vorbereiten kann, arbeitet meist klarer. Gerade bei jungen Unternehmen, in denen oft wenige Personen viele Rollen gleichzeitig übernehmen, ist das ein echter Vorteil.

Vorbereitung endet nicht mit der Anreise

Viele Eventtage scheitern nicht an mangelnder Motivation, sondern an zu wenig Struktur. Deshalb lohnt es sich, vorab einfache Fragen sauber zu klären. Welche Termine sind wirklich entscheidend? Wo braucht es bewusst freie Zeitfenster? Wer übernimmt welche Gespräche? Welche Unterlagen müssen jederzeit griffbereit sein?

Solche Punkte wirken unscheinbar, haben aber direkten Einfluss auf die Außenwirkung. Wer vorbereitet wirkt, schafft schneller Vertrauen. Wer im Ablauf ruhig bleibt, kann auch im Gespräch überzeugender auftreten. Gerade auf Messen, wo viele Eindrücke gleichzeitig auf Besucher und Aussteller einwirken, macht diese Form von Klarheit einen spürbaren Unterschied.

Auch das Umfeld beeinflusst den Auftritt

Ein weiterer Punkt wird oft übersehen: Der Ort rund um einen Termin beeinflusst mit, wie konzentriert und professionell ein Tag abläuft. Das gilt nicht nur für die Messehalle oder den Veranstaltungsraum selbst, sondern auch für alles davor und danach. Wo wird vorbereitet? Wo wird nach einem Gespräch noch kurz sortiert? Wo kann ein Team den Tag sinnvoll strukturieren?

Auch ein stilvolles Hotel Düsseldorf wird dort interessant, wo Geschäftstermine, Veranstaltungen und Vorbereitung nicht isoliert, sondern als zusammenhängender Arbeitsablauf gedacht werden.

Gerade in solchen Zusammenhängen zeigt sich, dass professionelle Präsenz mehr ist als reine Sichtbarkeit. Sie entsteht dort, wo Inhalt, Ablauf und Umfeld zusammenpassen. Hotels wie das Cloud One passen deshalb gut in dieses Bild, wenn junge Unternehmen einen Messe- oder Eventtag nicht nur absolvieren, sondern strukturiert und professionell aufsetzen wollen.

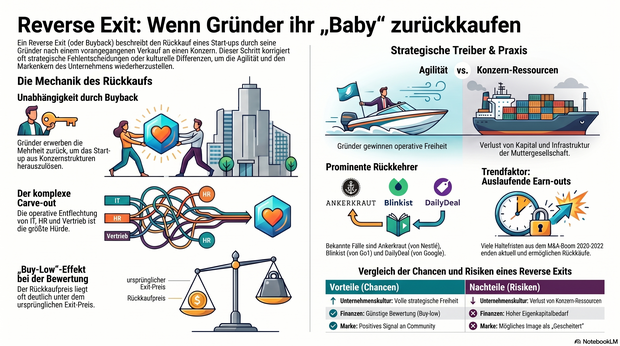

Reverse Exit: Wenn der Exit den Rückwärtsgang einlegt

In jüngster Zeit häufen sich in der Start-up-Szene Fälle, in denen Gründer*innen ihr Lebenswerk nach einem Exit überraschend zurückkaufen. Wir zeigen, was es mit dem Reverse Exit auf sich hat.

Für die meisten Gründer*innen ist er das ultimative Ziel auf der Start-up-Reise: der Exit. Doch was passiert, wenn die Traumhochzeit mit dem Konzern oder dem/der Großinvestor*in im Alltagstresor der Konzernstrukturen erstickt? Der sogenannte Reverse Exit rückt in den Fokus – und wirft für angehende wie gestandene Gründer*innen die Frage auf, ob ein Verkauf wirklich immer das Ende der eigenen Unternehmensgeschichte sein muss.

Was ist ein Reverse Exit?

Ein Reverse Exit (oft auch als Buyback oder Management Buyout / MBO nach einem vorherigen Verkauf bezeichnet) beschreibt den Vorgang, bei dem die ursprünglichen Gründer*innen oder das Managementteam die Mehrheit oder alle Anteile ihres Start-ups von dem/der bisherigen Käufer*in zurückerwerben. Das Start-up wird dadurch aus den Strukturen des Konzerns oder der Investor*innengruppe herausgelöst und agiert wieder als eigenständiges, unabhängiges Unternehmen.

Motivation der Beteiligten: Warum die Rolle rückwärts?

Ein Reverse Exit geschieht selten aus einer Laune heraus. Er ist zumeist das Ergebnis eines Reifeprozesses, bei dem beide Seiten erkennen, dass getrennte Wege wirtschaftlich und strategisch sinnvoller sind.

- Motivation der Gründer*innen (Käufer*innen): Oft prallen nach einem Exit die agile Start-up-Kultur und starre Konzernprozesse schmerzhaft aufeinander. Gründer*innen wollen die operative Entscheidungsgewalt zurückerlangen, eine verwässerte Markenidentität retten oder das Unternehmen schnell auf neue Markttrends (wie aktuell künstliche Intelligenz) ausrichten, was im Konzerngeflecht schlicht zu lange dauern würde.

- Motivation der Corporates (Verkäufer*innen): Konzerne trennen sich meist wieder von ihren Zukäufen, wenn das Start-up die erhofften Synergien nicht bringt oder die Umsätze nach der Übernahme stagnieren. Manchmal ändern sich auch die strategischen Kernziele des Mutterkonzerns, sodass das Start-up als „Non-Core-Asset“ wieder abgestoßen wird.

Vor- und Nachteile eines Reverse Exits

Der Rückkauf des eigenen „Babys“ mag romantisch klingen, ist wirtschaftlich aber ein enormer Kraftakt. Die wichtigsten Aspekte im Überblick:

Aspekt | Vorteile (Chancen) | Nachteile (Risiken) |

Unternehmenskultur | Volle strategische Freiheit und Rückbesinnung auf den ursprünglichen Markenkern | Verlust der Konzern-Ressourcen (Kapital, Vertriebsnetzwerk, Infrastruktur) |

Finanzen | Chance auf eine günstige Unternehmensbewertung beim Rückkauf (Buy-low-Effekt) | Hoher Kapitalbedarf für den Erwerb und das anschließende operative Geschäft |

Image & Marke | Starkes, positives Signal an die Community und Mitarbeiter („Wir sind wieder da“) | Reputationsrisiko bei künftigen B2B-Partner*innen, möglicher „Gescheitert“-Stempel |

Neben diesen offensichtlichen Punkten gibt es weitere, tieferliegende Schmerzpunkte, die bei einem Buyback zwingend auf dem Schirm sein müssen:

- B2B-Kund*innen und „Change of Control“-Klauseln: Große Enterprise-Kund*innen arbeiten oft gern mit Start-ups zusammen, weil im Hintergrund ein bonitätsstarker Konzern steht. Fällt dieses Sicherheitsnetz weg, greifen in Verträgen oft sogenannte Change of Control-Klauseln. Diese räumen den Kun*innen ein Sonderkündigungsrecht ein, weshalb wichtige Großkund*innen oft mühsam neu verhandelt werden müssen.

- Die Mitarbeitendenperspektive & ESOPs: Bei einem Exit werden Mitarbeitendenbeteiligungsprogramme (ESOPs/VSOPs) oft ausbezahlt und verfallen danach. Beim Rückkauf fängt das Start-up in Sachen Mitarbeitenden-Incentivierung oft wieder bei null an. Zudem bedeutet der Wegfall der Konzernstrukturen für manche Mitarbeitenden einen Verlust an Sicherheit (z.B. keine Konzern-Boni mehr), was den Buyback zu einem massiven HR-Kraftakt macht.

- Wem gehört das IP? (Geistiges Eigentum): Die Herauslösung von Patenten, Code oder Markenrechten, die während der Konzernzugehörigkeit entwickelt wurden, ist ein rechtliches Schlachtfeld. Gründer*innen müssen absichern, dass sie wirklich die uneingeschränkten Rechte an ihrem eigenen Produkt zurückkaufen.

Wie geht ein Reverse Exit vonstatten?

Der Prozess eines Rückkaufs ist oft deutlich komplizierter als der ursprüngliche Exit, da das Start.up bereits administrativ in den Konzern integriert wurde. Ein typischer Ablauf vollzieht sich in vier Schritten:

- Initiierung und Sondierung: Zumeist nach strategischen Differenzen oder Umstrukturierungen im Konzern treten die Gründer*innen mit einem Übernahmeangebot an den Eigentümer*innen heran.

- Unternehmensbewertung: Eine neue Due Diligence ist notwendig. Da das Wachstum im Konzern oft stagnierte oder Markenwerte gelitten haben, liegt der Kaufpreis häufig deutlich unter der damaligen Exit-Bewertung.

- Finanzierung: Die Gründer*innen müssen das Kapital aufbringen. Dies geschieht in der Regel durch das persönliche Vermögen aus dem ersten Exit, klassische Bankkredite oder die Hereinnahme spezialisierter Private-Equity-Partner*innen. Hier lauern zudem steuerliche Fallstricke: Der Rückkauf muss klug strukturiert werden (z.B. über eine Holding), um keine unnötigen steuerlichen Belastungen wie verdeckte Gewinnausschüttungen oder ungünstige Bewertungen durch das Finanzamt auszulösen.

- Carve-out (Herauslösung): Das ist die größte operative Hürde. IT-Systeme, HR-Prozesse, Buchhaltung und Vertriebslinien, die teilweise über Jahre mit dem Konzern verschmolzen wurden, müssen entflochten und eigenständig neu aufgebaut werden.

Reverse Exits in der Praxis: Von historischen Blueprints zu aktuellen Paukenschlägen