Aktuelle Events

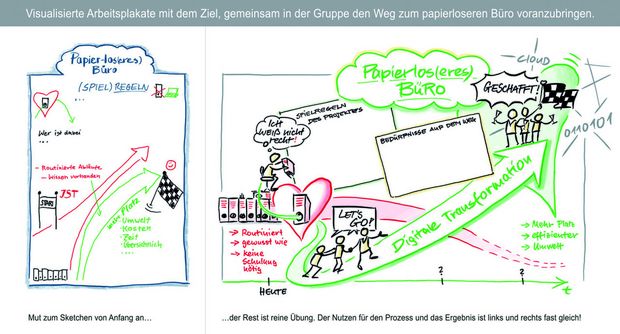

Sketchnoting statt Powerpoint

Beim Graphic Recording stellt Sketchnoting eine echte Alternative zu allzu oft gesehenen Strategiebilder dar, sofern es nicht zum schnöden Kreativwashing-Tool verkommt.

Den Begriff Greenwashing kennt inzwischen jede(r). Laut Definition werden bei dieser „Weiße-Weste“-Kommunikation Techniken der Öffentlichkeitsarbeit, der Rhetorik und der Manipulation benutzt, um einem Unternehmen, seinen Produkten und Aktivitäten einen grünen Anstrich zu geben.

Genauso, wie „Green“ zu sein, wollen viele Unternehmen heute betont agil, kreativ und innovativ wirken. Das verspricht Modernität, Attraktivität und zieht besonders job- und sinnsuchende junge Mitarbeiter*innen an. Das ist prinzipiell lobens- und erstrebenswert, sofern es keine Mogelpackung bzw. reines „Kreativwashing“ ist. Denn innovative Kreativität ist in Unternehmen zweifelsohne ein wettbewerbsentscheidender Punkt – aber nur, wenn diese Haltung gelebt wird und nicht nur ein Marketinghype ist.

Visualisierungen sind der emotionale Türöffner für den Intellekt

Vor diesem Hintergrund verwundert es nicht, dass in Veranstaltungen immer häufiger Visionen, Ideen oder Strategien in gesketchten Visualisierungen festgehalten werden. Beim sogenannten Sketchnoten bereitet man Inhalte visuell auf und fügt Elemente wie beispielsweise kleine Zeichnungen, Rahmen, Pfeile oder Letterings hinzu. Am Ende erhält man quasi Notizen mit Mehrwert.

Der Mehrwert dieser Art des visuellen Storytellings liegt darin, dass es mehr berührt als trockene Zahlen, Daten und Fakten. Visualisierungen sind der emotionale Türöffner für den Intellekt. Deshalb werden diese inspirierenden, gesketchten Bilder gern angeschaut, bewundert und geteilt. Der Aufmerksamkeitsfaktor ist größer als bei üblichen PowerPoint Slides. Visualisierungen sind nicht nur ein Hingucker bei Veranstaltungen, sondern werden zudem als attraktive Abbildungen in Dokumentationen oder für die Social-Media-Auftritte genutzt.

Worauf es beim Sketchen wirklich ankommt

Künstlerische Qualität vs. gehaltvoller Inhalt

Die künstlerisch-ästhetische Qualität von Visualisierungen ist über die letzten Jahre immer professioneller geworden. Kein Wunder, denn inzwischen haben immer mehr professionelle Illustrator*innen und Graphiker*innen diesen Markt zum Geldverdienen entdeckt. Doch hohes künstlerisches Niveau ist eigentlich nicht das, worauf es beim Sketchen geht. Sketches sind sichtbar gemachte Gedanken, sind clevere, merk-würdige Zusammenfassungen. Also kommt es auf die Qualität der Gedanken an. Auf die Fähigkeit, das Gehörte zu verstehen, zu interpretieren und intelligent auf den Punkt zu bringen.

Je mehr Fachkenntnis der/die Visualisierer*in zum jeweiligen Thema einbringen kann, je wacher sein/ihr Geist ist, desto gehaltvoller wird die Visualisierung werden. Und hier liegen das Problem und die Kritik: Diese Fachkenntnis, bringt ein(e) hervorragende(r) Kreative(r) nicht per se mit.

So könnte das Wandbild von sketchenden Ingenieur*innen oder Personalverantwortlichen weitaus mehr Substanz haben als jenes von begnadeten Profi-Zeichner*innen. Deshalb ist beim Graphic Recording, bei dem das Gesagte in Echtzeit grafisch festgehalten wird, der hübsche Augenschein nicht das einzige Kriterium – genauso wenig, wie das glänzende Geschenkpapier mit Goldschleife oder eine glänzend polierte Karosserie. Es kommt darauf an, was mit dem Geschenkpapier eingewickelt worden ist bzw. unter der Haube steckt.

Visuelle Kommunikationskultur statt bewundernde Konsumhaltung

Warum haben nicht mehr Unternehmen den Mut, die Teilnehmenden eines Events selbst an den Stift zu bringen, statt das übliche Event-Graphic-Recording zu praktizierten? Denn das gelingt mithilfe einer kurzen Anleitung durchaus! So werden aus rein Betrachtenden skizzierende Akteur*innen. Noch besser wäre es, Sketches nicht nur bei einem Event zu nutzen, sondern täglich am Arbeitsplatz.

Unternehmen, die diesen Schritt wagen, erleben, dass die vielen kleinen Sketches im Geschäftsalltag von der Wirkung her durchaus mit den eindrucksvollen Wandbildern der Zeichen-Profis mithalten können – hinsichtlich der Wirkung auf Menschen, um bessere Ergebnisse zu erzielen. Denn gerade die Visualisierungen der Mitarbeiter*innen und Führungskräfte helfen, Gedanken zu entwickeln und zu teilen. Das Beuys’sche „Jeder ist Künstler“ wird so zum „Jede(r) ist Sketchnoter*in“. Dann wird das eindrucksvolle professionelle Wandbild ein Teil der visuellen Kommunikationskultur des Unternehmens – und eine noch viel wertvollere Inspiration.

Vom Kreativwashing zur echten Kreativität

Kreativität ist stets ein Weg von unten nach oben. Sie wird nicht von oben eingekauft, sondern die Teams und Mitarbeitenden müssen entsprechend gefördert werden. Fördern heißt hierbei oftmals, einfach nur zuzulassen, dass nicht nur PowerPoint-Folien nach strengem CI erlaubt sind bzw. reine Textnotizen Teil der Kommunikationskultur sein dürfen. Denn gerade die Kommunikationsform Sketchnoten bringt eine weitere Dimension in den Austausch. Wie schon erwähnt: Das rein Sachliche wird mittels Sketchen emotional oder durch eine Metapher verpackt. Das ist zielführend. Denn was berührt, kann besser gären. Auch das Trainieren der sogenannten doppelten Kodierung einer Botschaft durch Bild und Notiz (SketchNote) hilft beim Merken und Verstehen – dem/der Sketchenden genauso wie seinen/ihren Ansprechpartner*innen.

Ein zu hoher Anspruch hemmt – fang einfach an

Das gilt nicht nur, wenn es um Visualisierungen geht. Zu exzellenten Ergebnissen schaut man bewundernd auf. In dieser Das-kann-ich-nie-Haltung vergleicht man allzu schnell seine Anfänger*in-Ergebnisse mit jenen der Profis. Man vergleicht allzu leicht die Optik und nicht die Substanz einer Visualisierung. Nehmen wir den Vergleich vom Anfang nochmals auf: Der glänzende Lack ist nicht gleichbedeutend mit der Qualität unter der Haube. Wenn man vorankommen möchte, hilft die Motorisierung. Das Blech der Visualisierung ist die reine Optik, die Gewandtheit der Zeichenkünste – die Motorisierung ist die Struktur, der bedeutungsstarke Inhalt und das gelungene Storytelling. Und alles lässt sich auch mit krakeligen einfachen Skizzen ausdrücken.

Gewandtheit im Skizzieren ist vor allem Übung

Dass Visulisierungs-Profis in ihre Fähigkeit schier unzählige Stunden investiert haben, weiß man zwar, wird aber im Vergleichsfrust oft vergessen. Das Gute am Visualisieren bzw. dem Erlernen von Sketchnoting ist aber, dass es um Sprachenlernen geht und nicht darum, Künstler*in zu werden. Darüber hinaus ist Visualisieren eine einfache Sprache, die du als Kind schon einmal perfekt konntest – bis dir vielleicht im Kunstunterricht die Noten den Spaß verdorben haben, dich mit Zeichnungen und Bildern auszudrücken.

Die Grundlagen, Gedanken visuell zu Papier zu bringen, kannst du in wenigen Stunden lernen. Du wirst schon nach wenig Übung erleben, wie nützlich deine Skizzen sind – nicht nur in der Geschäftskommunikation. Fange das Visualisieren ganz einfach an, mit wenigen visuellen Worten. Und trau dich von Anfang an, diese Sprache zu sprechen. Du wirst schnell merken, dass dich dieser Elementarwortschatz täglich weiterbringt. Und übe weiter, fürs Visualisieren gibt es täglich Gelegenheit. Durch das Learning by Doing kannst du dich bald fließend visuell ausdrücken. Und auch hier ist es wie bei einer Fremdsprache: Manches fehlende Wort oder witzige Umschreibungen für fehlende Worte sowie ein Akzent wirken besonders sympathisch.

Der Vergleich mit dem Sprachenlernen hilft dir auch dabei, das Visualisieren effektiver zu erlernen. Es gilt: Gezielte Übungen und Impulse zusätzlich zur täglichen Sprachpraxis bringen dich schneller zum Ziel. Lass dich deshalb von einer guten Anleitung oder durch einen Workshop motivieren und inspirieren. Und wenn es um das Inspirieren geht, taugen die Visualisierungen der Profis. Aber versuche, das demotivierende Vergleichen zu unterlasen.

Noch ein letzter Gedanke zur Motivation

Du kennst es vielleicht vom Musikhören oder Sporttreiben: Oft sind es gerade die Nicht-Profis, die sich besonders aufs Training freuen und mehr Spaß beim Spiel haben. So geht es auch fast allen, die beginnen, den Stift immer öfter in die Hand zu nehmen. Dazu kommen die Quick Wins von Anfang an. Es gilt: Was hilft, wird beibehalten. Was also spricht gegen eine kreativ-visuelle Kommunikationskultur in deinem Unternehmen, statt schnödem Kreativwashing?

Tipp zum Weiterarbeiten: Das Sachbuch des Autors dieses Beitrags – Sigi Bütefisch: Clever visualisieren, ISBN: 978-3-86980-707-2, BusinessVillage 2023, ca. 240 Seiten, 24,95 Euro

Diese Artikel könnten Sie auch interessieren:

Produktivität statt Überstunden: Wie Echtzeitdaten das Finanzwesen von morgen steuern

Das KI-gestützte Fintech Embat beendet das Excel-Chaos im Treasury und macht Finanzteams mit Echtzeitdaten fit für die Zukunft.

Berlin, 28. April 2026 – Es ist ein bekanntes Bild in den Finanz- und Treasury-Abteilungen des deutschen Mittelstands: Wenn der Monatsabschluss naht oder Ad-hoc-Berichte für die Geschäftsführung benötigt werden, bleiben die Schreibtischlampen bis spät in die Nacht an. Die manuelle Zusammenführung von Daten aus unterschiedlichen Bankportalen und historisch gewachsenen Excel-Listen kostet nicht nur Nerven, sondern vor allem wertvolle Zeit.

Das schnell wachsende Fintech Embat tritt an, um genau diesen Engpass aufzulösen. André Reimers, Head of DACH, treibt diese Mission im deutschsprachigen Raum als Gesicht des Unternehmens voran. Seine Kernüberzeugung: Wer heute noch regelmäßig Überstunden machen muss, um finanzielle Transparenz zu schaffen, leidet nicht unter mangelnder Einsatzbereitschaft – er leidet unter einem strukturellen Datenproblem.

Beeindruckendes Wachstum durch das Lösen echter Pain Points

Dass der Schmerz in den Finanzabteilungen groß und der Bedarf an modernen Lösungen riesig ist, belegen die Zahlen, mit denen Embat den europäischen Markt aufrollt. Mit einem starken Kundenwachstum im deutschen Markt von über 250 Prozent im vergangenen Jahr und mittlerweile mehr als 400 mittelständischen und großen Unternehmenskunden weltweit hat sich das Fintech als fester Player etabliert. Das stetig wachsende Transaktionsvolumen von 250 Millionen Euro zeigt deutlich: Der Wechsel von fehleranfälligen Tabellen zu automatisierten Cloud-Lösungen ist in vollem Gange.

Der Weg aus der Excel-Falle

Mit seiner Technologie nimmt Embat den Kampf gegen ineffiziente Prozesse im Treasury auf. Anstatt hochqualifizierte Mitarbeiter mit repetitiver Datenpflege zu binden, automatisiert das System die Konsolidierung aller relevanten Finanzdaten.

„Die Erwartungshaltung, dass komplexe Finanzanalysen zwingend mit langen Abenden im Büro einhergehen müssen, ist schlichtweg nicht mehr zeitgemäß“, erklärt André Reimers. „Wenn Cashflow, Liquidität und Runways per Knopfdruck in Echtzeit abrufbar sind, ändert sich die gesamte Arbeitsdynamik. Finanzteams können aus dem reaktiven Modus heraustreten und sich auf die strategische Steuerung des Unternehmens konzentrieren.“

Hohe Innovationskraft trifft auf lokales DACH-Verständnis

Embat profitiert von einer enormen Innovationsgeschwindigkeit und Agilität, auf der die starke technologische Basis des Unternehmens beruht. Wie diese passgenau auf die spezifischen Bedürfnisse des deutschen Marktes übersetzt wird und für eine hohe lokale Marktpräsenz sorgt, zeigt André Reimers an den Standorten in München und Berlin.

Von diesen beiden Standorten aus steuert André Reimers das DACH-Geschäft und stellt das tiefe Verständnis für die komplexen Strukturen und hohen Sicherheitsbedürfnisse des deutschen Mittelstands sicher. Das Team zeigt dabei, wie moderne, dezentrale Zusammenarbeit erfolgreich funktioniert. Das Vertrauen der stetig wachsenden deutschen Kundenbasis fußt dabei auf dieser geballten lokalen Expertise gepaart mit der unerschütterlichen Zuverlässigkeit der Systeme.

Führen durch Resultate, nicht durch Anwesenheit

Die Botschaft an die Finanzwelt ist klar: Moderne Führung, hohe Produktivität und Skalierbarkeit erfordern keine starren Kontrollmechanismen oder endlosen Arbeitstage. Sie erfordern radikale Datentransparenz und die richtigen digitalen Werkzeuge. Wenn die Daten in Echtzeit fließen, sinkt die Fehlerquote, die Entscheidungsgeschwindigkeit steigt – und die systembedingten Überstunden im Treasury gehören endgültig der Vergangenheit an.

Über Embat:

Embat ist ein KI-gestütztes FinTech mit Schwerpunkt auf Treasury-Management, das es mittelständischen Unternehmen und Großkonzernen ermöglicht, ihre Finanzprozesse in Echtzeit zu zentralisieren. Gegründet von Antonio Berga und Carlos Serrano – ehemaligen J.P. Morgan-Managern mit umfassender Erfahrung im Corporate Banking – sowie Tomás Gil, dem ehemaligen CTO von Fintonic, entstand die Plattform mit der Mission, die Finanzabteilung zu digitalisieren. Die klare Prämisse dabei: Technologie von Finanzexperten für Finanzexperten.

Durch seine hybride Konnektivität lässt sich Embat in über 15.000 Banken und führende ERP-Systeme integrieren und beseitigt so jegliche Datenfragmentierung. Das wichtigste Alleinstellungsmerkmal ist TellMe, ein „Agentic Treasury Analyst“ (autonomer KI-Analyst), der Cashflow-Muster erkennt, komplexe Kontenabstimmungen automatisiert und strategische Entscheidungen zur Optimierung der Liquidität vorschlägt.

Mit Niederlassungen in Madrid, London, Berlin und München definiert Embat die Zukunft des Corporate Finance neu.

Stallgrün: Mit Hightech-Kräutern gegen den Agrar-Strukturwandel

Leere Ställe als Chance: das 2023 von Judith Ryll und Thorsten Lansmann-Niehaus gegründete Stallgrün nutzt Bestandsbau für Indoor Farming. Wir checken das Modell hinter der aktuellen 125.000-€-DBU-Förderung.

Der Strukturwandel in der deutschen Landwirtschaft ist unaufhaltsam: Allein zwischen 2013 und 2023 ging die Zahl der hiesigen Betriebe mit Schweinehaltung um 44 Prozent zurück, wie Zahlen des Bundesministeriums für Ernährung und Landwirtschaft (BMEL) belegen. Jedes Jahr geben Landwirt*innen auf. Zurück bleiben leere Ställe – und Landwirtschaftsbetriebe auf der Suche nach neuen finanziellen Perspektiven.

Das 2023 in Münster gegründete Start-up Stallgrün will aus diesen „Stranded Assets“ einen lukrativen Zukunftsmarkt formen: Indoor Farming im ehemaligen Schweinestall. Die Deutsche Bundesstiftung Umwelt (DBU) unterstützt das Projekt aktuell mit 125.000 Euro im Rahmen ihrer Green Startup-Förderung. Wir wollten wissen: Wie tragfähig ist das Modell jenseits der Fördergelder wirklich?

Die Köpfe hinter der Idee & die Historie

Hinter Stallgrün stehen die Gründer Judith Ryll und Thorsten Lansmann-Niehaus. Ryll bringt als Biowissenschaftlerin tiefe Expertise in der Pflanzenbiologie mit, während Lansmann-Niehaus – der bezeichnenderweise selbst auf einem Schweinemastbetrieb aufwuchs – die kaufmännische Führung übernimmt. Gefördert durch regionale Inkubatoren wie das Seedhouse, hat das Duo den technologischen Machbarkeitsnachweis bereits erbracht: In den vergangenen zwei Jahren wurde das Konzept auf einer Pilotfarm erfolgreich entwickelt.

Das Geschäftsmodell: Mehr als nur Hardware

Die Grundprämisse ist so simpel wie pragmatisch: Ehemalige Schweineställe sind in der Regel massiv gebaut sowie gut isoliert und bieten damit architektonisch ideale Bedingungen für den ganzjährigen Anbau von regionalen Kräutern und Gemüse. Stallgrün positioniert sich als B2B-Technologie- und Service-Provider für Höfe im Wandel und will deutschlandweit agieren. Das System fußt auf drei wesentlichen Säulen:

- Automatisierte Anlagentechnik: Als Kernprodukt hat das Start-up während der DBU-Förderung eine Anlage entwickelt, welche die Bewässerung, Düngung, Belichtung und Klimatisierung automatisiert steuert.

- Datengetriebene Agrar-Software: Ergänzend liefert das Team spezifische Anbauprotokolle für die teilnehmenden Betriebe. Für geeignete Kulturen wurde der optimale Einsatz von Parametern wie Saatgut, Erde, Dünger, Licht und Bewässerungszyklen definiert.

- B2B-Ökosystem: Um die Einstiegshürde zu minimieren, hat Stallgrün einen Materialhandel für passendes Anbaumaterial aus einer Hand aufgebaut und bietet rechtliche Hilfen bei der Verwaltung an. Zudem unterstützt das Start-up beim Aufbau der Vermarktung.

Stallgrün versteht sich dabei nicht als Feind der traditionellen Landwirtschaft. Laut Lansmann-Niehaus ist Indoor Farming kein Ersatz für den etablierten Freiland- oder Gewächshausanbau, sondern eine wetter- und klimaunabhängige Ergänzung.

Die Vision: Produkte sollen ganzjährig regional verfügbar gemacht werden. Die vermehrte Nutzung regionaler Lebensmittel anstelle von Importen reduziere zudem den Transportaufwand und die daraus entstehenden Emissionen.

Kritische Markteinordnung

Der Markt für Vertical- und Indoor-Farming ist ein hartes Pflaster. Prominente Branchenvorreiter wie das ehemals hochgelobte Berliner Start-up Infarm haben in der Vergangenheit massiv Risikokapital verbrannt, weil die schiere Skalierung von energieintensiven Hightech-Farmen in urbanen Ballungsräumen betriebswirtschaftlich oft zum Scheitern verurteilt war.

Hier liegt der geniale, aber auch kritische Hebel von Stallgrün: Anstatt teure Gewerbeimmobilien anzumieten, nutzt das Team bestehende, ländliche Infrastruktur. Das verhindert eine zusätzliche Versiegelung von Flächen, was auch DBU-Generalsekretär Alexander Bonde als zentralen ökologischen Faktor hervorhebt. Ein weiterer Wettbewerbsvorteil: Viele Höfe verfügen bereits über großflächige Photovoltaikanlagen auf ihren Stalldächern. Damit lässt sich der enorme Strombedarf für die Belichtung und Klimatisierung teilweise direkt durch eigenen, günstigen Sonnenstrom abdecken.

Dennoch bleiben aus unserer Sicht drei gravierende Hürden für das Geschäftsmodell:

- CAPEX-Intensität: Die Umrüstung eines leeren Stalls in eine funktionsfähige Hightech-Anlage ist extrem kapitalintensiv. Es bleibt fraglich, wie Landwirte, die gerade aus der unprofitablen Schweinehaltung ausgestiegen sind, das nötige Investitionskapital für diesen Hardware-Neustart bei ihren Banken abrufen können.

- Radikaler Kulturwandel: Einen traditionellen Schweinemäster in einen agilen, datengetriebenen Indoor-Kräuterproduzenten zu transformieren, erfordert enormen Beratungs- und Change-Management-Aufwand seitens Stallgrün.

- Wettbewerb & Margendruck: Die teilnehmenden Bauern und Bäuerinnen kämpfen letztlich gegen die extrem knappen Margen des Lebensmitteleinzelhandels.

Unser Fazit

Stallgrün liefert einen erfrischend bodenständigen „Hardware-meets-Agrar“-Ansatz in einem Tech-Segment, das lange Zeit von utopischen, rein urbanen Vertical-Farming-Träumereien dominiert wurde. Durch die kluge Umnutzung von Infrastruktur-Altlasten und die clevere Kombination aus Hardware, Software-Protokollen und einem integrierten B2B-Serviceangebot hat das Duo ein System aufgebaut, das ein hohes Skalierungspotenzial besitzt.

Die DBU-Förderung von 125.000 Euro ist ein sauberes Validierungssignal für den positiven ökologischen Impact der Gründer*innen. Die wahre Reifeprüfung wird nun jedoch in den Bilanzen der kooperierenden Landwirte stattfinden: Nur wenn die Höfe durch den automatisierten Anbau zügig ihre hohen Anfangsinvestitionen amortisieren können, wird aus dem Münsteraner Pilotprojekt ein neuer bundesweiter Agrar-Standard. Ein mutiger Pivot für die heimische Landwirtschaft – und ein Start-up, das man als Investor*in und Beobachter*in der Agrar-Wende unbedingt auf dem Zettel haben sollte.

5 Mio. Euro für die „Schreibtischlosen“: Kann Elephant den Frontline-Markt wirklich digitalisieren?

Operative Teams in der Produktion, der Logistik oder im Service gelten bei der Digitalisierung oft als vernachlässigt. Das Berliner Start-up Elephant verspricht Abhilfe durch KI-gestütztes Micro-Learning und sicherte sich dafür nun 5 Millionen Euro. Doch zwischen dem PR-Versprechen und der harten Shopfloor-Realität warten ein eng besetzter Markt und die Gefahr der technologischen Austauschbarkeit.

Die aktuelle Finanzierungsrunde wird von den Corporate-Venture-Capital-Einheiten (CVC) EnBW New Ventures und Wepa angeführt. Dass ausgerechnet diese Player investieren, ist kein Zufall: Die Mutterkonzerne steuern selbst riesige operative Belegschaften. Sie dienen der Elephant Technologies GmbH somit nicht nur als Geldgeber, sondern gleichzeitig als Testlabor und Referenzkund*innen. Ergänzt wird die Runde durch namhafte Angel-Investoren aus dem Umfeld von Flix und Home24.

Das Geschäftsmodell: KI-Kurse gegen das „Wissens-Leck“

Die Gründer Maurice Zomorrodi, Niklas Dehio und Melchior Schramm riefen Elephant im Sommer 2022 ins Leben. Sie adressieren ein strukturelles Problem: Wissen wird in operativen Betrieben oft noch mündlich oder über veraltete Handbücher weitergegeben. Die Elephant-Plattform nutzt einen KI-gestützten „Coursebuilder“, um aus bestehenden Dokumenten mit wenigen Klicks interaktive Lerneinheiten für eine mobile App zu generieren. Ein KI-Assistent soll Fragen zudem kontextbezogen direkt am Arbeitsplatz beantworten. Um Sprachbarrieren in der Industrie abzubauen, bietet das System Übersetzungen in über 95 Sprachen. Dass das Modell Anklang findet, zeigt sich am Solar-Einhorn Enpal, das Elephant zur Schulung von Quereinsteigern nutzt.

Journalistisch betrachtet muss man jedoch das Preisschild hinterfragen: Der Einstieg in die Plattform beginnt bei 640 Euro monatlich für bis zu 50 Nutzer*innen („Team“) und skaliert über 1.300 Euro („Pro“) bis hin zu Enterprise-Lösungen ab 4.000 Euro im Monat. Für Mittelständler*innen ist das ein beachtlicher Kostenblock, der sich zügig durch messbar sinkende Fehlerquoten oder kürzere Onboarding-Zeiten rechtfertigen muss.

Ein Markt im Goldrausch: Wer sind die Jäger*innen?

Elephant ist längst nicht allein auf der Jagd nach der „Deskless Workforce“. Dieses enorme Segment hat in den letzten Jahren mächtige Wettbewerber auf den Plan gerufen. So hat beispielsweise der Branchen-Riese Beekeeper die Frontline-Trainingsplattform eduMe nahtlos in seine App integriert, um Mitarbeitenden Weiterbildung mit nur einem Klick zugänglich zu machen. Solche Konsolidierungen zeigen: Der Standard im operativen Weiterbildungsmarkt wird zunehmend höher.

Zwischen Innovation und Commodity

Trotz des Kapitalschubs steht das Start-up vor zwei entscheidenden Hürden. Erstens droht der technologische Kern – das Umwandeln von PDFs in Quizze mittels KI – zu einer reinen „Commodity“ zu werden. Da große Sprachmodelle (LLMs) rasant mächtiger werden, könnten generische Unternehmenstools diese Funktion bald als Standard-Feature mitliefern. Elephant muss beweisen, dass sich die Plattform unverzichtbar tief in echte Qualitätssicherungs- und Produktionsprozesse verwebt.

Zweitens bleibt der Faktor Mensch das größte Risiko. Software für den Shopfloor scheitert selten am Management, sondern oft an der fehlenden Akzeptanz der Belegschaft. Wenn die App im stressigen Arbeitsalltag nicht als spürbare Entlastung wahrgenommen wird, nützt auch die beste KI wenig.

Unser Fazit

Ein valider Ansatz unter hohem Konkurrenzdruck Elephant hat mit EnBW und Wepa die idealen Partner gefunden, um die Praxistauglichkeit in großen Strukturen unter Beweis zu stellen. Die 5 Millionen Euro geben den nötigen Runway. Dennoch ist der technologische Burggraben schmal. Um langfristig gegen internationale Schwergewichte zu bestehen, muss Elephant mehr sein als nur ein komfortabler Content-Generator. Der echte Härtetest beginnt an der Werkbank.

Von Streaming bis Gaming – Diese Branchen profitieren vom digitalen Nutzerverhalten

Wie On-Demand-Modelle Branchen prägen und welche Erfolgsfaktoren Gründer jetzt kennen müssen.

Inhalte, Dienstleistungen und Unterhaltung werden zunehmend flexibel, mobil und individuell konsumiert. Während früher feste Zeiten und physische Angebote dominierten, stehen heute On-Demand-Modelle im Mittelpunkt. Diese Entwicklung wirkt sich nicht nur auf einzelne Produkte aus, sondern prägt ganze Branchen und schafft neue wirtschaftliche Dynamiken. Insbesondere digitale Geschäftsmodelle profitieren von der steigenden Erwartung an Verfügbarkeit, Geschwindigkeit und Personalisierung.

Digitales Nutzerverhalten im Wandel

Die Verschiebung der Nutzungsgewohnheiten von stationären Desktop-Lösungen hin zu mobilen Endgeräten ist der stärkste Treiber der aktuellen Digitalökonomie. On-Demand ist zum Standard geworden: Ob Content, Services oder Unterhaltung – die Erwartungshaltung der Konsumenten ist geprägt von sofortiger Verfügbarkeit und einer hohen Passgenauigkeit durch Personalisierung.

- Inhalte jederzeit abrufbar: Die zeitliche Entkopplung von linearen Sendeplänen oder Öffnungszeiten.

- Omnichannel-Nutzung: Ein nahtloser Übergang zwischen Smartphone, Tablet, Smart-TV und Laptop.

- Komfort als Zahlungsargument: Eine wachsende Bereitschaft, für Zeitersparnis und einfache Bedienbarkeit Abonnements abzuschließen.

Streaming als Vorreiter der digitalen Transformation

Streaming-Dienste gelten als eines der prägendsten Beispiele für die Anpassung an modernes Nutzerverhalten. Klassische Medienformate wurden durch Plattformen ersetzt, die Inhalte jederzeit zugänglich machen. Gleichzeitig haben sich abonnementbasierte Modelle etabliert, die stabile und planbare Einnahmen ermöglichen.

Ein zentraler Erfolgsfaktor liegt in der Nutzung von Daten. Algorithmen analysieren das Verhalten der Nutzer und liefern personalisierte Empfehlungen, wodurch die Verweildauer und Kundenbindung gesteigert werden. Für Unternehmen ergibt sich daraus ein skalierbares Modell, das sich international ausrollen lässt und kontinuierlich optimiert werden kann. Die Grenzkosten pro neuem Nutzer sind minimal. Eine starke Kundenbindung erfolgt hier primär durch exklusiven Content und ein personalisiertes Interface.

In diesem Bereich steht allerdings eine Wende bevor. Durch die große Akzeptanz und Nachfrage sind zahlreiche Angebote und dadurch ein fragmentierter Markt entstanden. Mehrere Abos pro Haushalt sind die Regel und Nutzer wünschen sich zunehmend eine Bündelung.

Gaming und interaktive Unterhaltung auf dem Vormarsch

Gaming hat sich von einer Nische zu einem der weltweit größten digitalen Märkte entwickelt und übertrifft in den Umsätzen längst die Film- und Musikindustrie zusammen. Besonders entscheidend ist hier der soziale Aspekt: Community-Building innerhalb der Spielewelten macht Gaming zu einem sozialen Netzwerk. Der Übergang zu Live-Events und Multiplayer-Erlebnissen schafft eine emotionale Bindung, die weit über das reine Konsumieren hinausgeht.

Gleichzeitig verschiebt sich der Fokus von einmaligen Käufen hin zu kontinuierlichen Einnahmequellen, etwa durch In-Game-Käufe oder abonnementbasierte Modelle. Diese Entwicklung zeigt, wie stark Nutzererlebnisse und soziale Komponenten den Erfolg digitaler Angebote beeinflussen.

iGaming als Teil der digitalen Entertainment-Ökonomie

Innerhalb der digitalen Unterhaltungslandschaft nimmt auch der iGaming-Bereich eine besondere Rolle ein. Dieser Sektor profitiert in ähnlicher Weise von technologischen Entwicklungen wie Streaming und Gaming, insbesondere durch mobile Nutzung, intuitive Benutzeroberflächen und schnelle Transaktionsmöglichkeiten.

Die Plattformen sind darauf ausgelegt, ein möglichst reibungsloses und immersives Nutzererlebnis zu bieten. Online Casino Schweiz präsentiert eine klare Strukturierung unterschiedlicher Games sortiert nach Themen oder Anbietern. Above the fold finden Nutzer Infos zu aktuellen Top-Gewinnern, Verlosungs-Aktionen oder neuen Titeln. Die Kombination aus Gamification-Elementen, internationaler Skalierbarkeit und datenbasierter Optimierung macht diesen Markt aus wirtschaftlicher Perspektive besonders interessant.

Typische Merkmale dieser Branche sind:

- hohe Nutzerbindung durch spielerische Elemente

- globale Ausrichtung digitaler Plattformen

- kontinuierliche Anpassung durch Nutzerdaten

Wirtschaftlichkeit und Transferpotenzial

Die Branche zeichnet sich durch überdurchschnittlich hohe operative Margen aus, da nach der initialen Entwicklung der Plattform und der Integration von Content die Skalierungskosten gering bleiben. Während Marketing- und Lizenzkosten substanziell sind, ermöglichen automatisierte Prozesse in der Kundenverwaltung und Zahlungsabwicklung eine hohe Profitabilität.

Diese Effizienz lässt sich auf andere digitale Angebote übertragen: Das Prinzip der Mikro-Interaktionen und die sofortige Belohnung (Instant Gratification) sind Mechanismen, die auch im E-Commerce oder in Produktivitäts-Apps die Conversion-Rate steigern. Wer lernt, die im iGaming perfektionierten Methoden der Datenanalyse und Echtzeit-Personalisierung zu nutzen, kann die Kundenbindung in nahezu jedem digitalen Geschäftsmodell signifikant erhöhen.

Was Gründer daraus lernen können

Die Analyse erfolgreicher digitaler Branchen zeigt klare Muster. Im Mittelpunkt steht nicht die Technologie selbst, sondern deren Anwendung im Kontext realer Nutzerbedürfnisse. Plattformdenken, Datenanalyse und eine konsequente Ausrichtung auf Benutzerfreundlichkeit sind zentrale Erfolgsfaktoren.

Konkrete Impulse:

- Verhalten statt Produkt: Geschäftsmodelle sollten dort ansetzen, wo Nutzer bereits Zeit verbringen oder Reibungsverluste erleben.

- Iteration: Schnelles Testing von Funktionen (MVP-Ansatz) ermöglicht es, am Puls der Zielgruppe zu bleiben.

- Mobile-First-Denkweise: Jede Lösung muss primär auf dem kleinsten Bildschirm perfekt funktionieren.

- Entwicklung skalierbarer Plattformlösungen

Das digitale Nutzerverhalten entwickelt sich dynamisch weiter und beeinflusst zahlreiche Branchen nachhaltig. Unternehmen, die diese Veränderungen frühzeitig erkennen und in ihre Strategien integrieren, sichern sich entscheidende Wettbewerbsvorteile. Besonders erfolgreich sind Modelle, die Flexibilität, Personalisierung, einfache Zugänglichkeit und die Einbindung in starke App-Ökosysteme miteinander verbinden. In einer zunehmend digitalen Wirtschaft entstehen neue Chancen vor allem dort, wo technologische Möglichkeiten auf veränderte Erwartungen treffen.

Weitere Gewinner des Nutzerwandels

Neben Unterhaltung und Gaming profitieren auch andere Branchen vom veränderten Verhalten. Besonders deutlich wird dies in Bereichen, die auf flexible Nutzung und personalisierte Angebote setzen.

Dazu zählen unter anderem:

- E-Learning-Plattformen, die ortsunabhängiges Lernen ermöglichen

- Fitness- und Gesundheits-Apps, die individuelle Trainingspläne bieten

- Fintech-Lösungen, die schnelle und unkomplizierte Zahlungsprozesse unterstützen

Gemeinsam ist diesen Geschäftsmodellen eine starke Nutzerzentrierung. Sie bieten Lösungen, die sich nahtlos in den Alltag integrieren lassen und dabei individuelle Bedürfnisse berücksichtigen.

Was Gründer daraus lernen können

Der entscheidende Erfolgsfaktor in der digitalen Ökonomie ist die radikale Nutzerzentrierung. Erfolgreiche Unternehmen denken nicht mehr in isolierten Produkten, sondern in Plattformen, die ein Problem ganzheitlich lösen. Die Bedeutung von Datenanalyse zur stetigen Verbesserung der UX kann dabei nicht überschätzt werden.

Die Verfestigung digitaler Gewohnheiten ist ein unumkehrbarer Prozess. Neue Märkte werden dort entstehen, wo technologische Möglichkeiten auf neue menschliche Bedürfnisse treffen. Die größten Chancen liegen für Gründer und etablierte Unternehmen dort, wo sich das Nutzerverhalten schneller wandelt als die bestehenden, oft noch trägen Angebote am Markt.

DeepTech trifft Food-Safety: 2,6 Mio. Euro für NanoStruct

Food-Safety-Revolution? NanoStruct weist Bakterien in Stunden statt Tagen nach & holt 2,6 Mio. € Seed-Kapital. Wir machen den DeepTech-Check.

Frische Lebensmittel sind ein Wettlauf gegen die Zeit. Bislang dauert der Nachweis von gefährlichen Erregern wie Salmonellen oder Listerien oft mehrere Tage – ein erhebliches Risiko für verderbliche Waren. Das Würzburger Uni-Spin-off NanoStruct will diesen Engpass mit einer neuen Analyseplattform beheben und hat dafür nun eine Seed-Finanzierung in Höhe von 2,6 Millionen Euro eingesammelt. Doch wie tragfähig ist das DeepTech-Modell in der konservativen Lebensmittelindustrie wirklich?

Das Würzburger Startup NanoStruct tritt an, um die mikrobiologische Lebensmittelanalyse von Grund auf zu beschleunigen. Durch die Kombination von optischer Messtechnik, Nanotechnologie, Biotechnologie und maschineller Datenauswertung soll der Nachweis pathogener Bakterien von mehreren Tagen auf wenige Stunden schrumpfen.

Die aktuelle Seed-Runde über 2,6 Millionen Euro bringt namhafte Investoren an Bord: Angeführt wird die Runde vom High-Tech Gründerfonds (HTGF), Bayern Kapital und dem AUXXO Female Catalyst Fund. Ergänzt wird das Kapital durch drei Business Angels aus dem Netzwerk von BayStartUP.

Gold-Antennen statt Petrischalen

Im Kern basiert das Verfahren von NanoStruct auf der sogenannten Surface-enhanced Raman Spectroscopy (SERS). Die Sensoren nutzen dabei ultrapräzise Gold-Nanoantennen, um selbst geringste Mengen von Bakterien verlässlich zu identifizieren.

Interessant ist hierbei ein Blick auf die technologischen Versprechungen: Während das Startup in jüngsten Einreichungen für Branchenpreise (wie den AMA Innovationspreis 2025) noch explizit von einem "Drei-Minuten-Bakterientest" sprach, stapelt die aktuelle Pressemitteilung etwas tiefer und verspricht eine Verkürzung auf "wenige Stunden". Dies ist ein bekanntes Phänomen in der Bio-Sensorik: Während die reine optische Messung im Labor oft nur Minuten dauert, nimmt die komplexe Probenaufbereitung aus realen, unsauberen Lebensmittelmatrizen in der Praxis weiterhin Stunden in Anspruch. Dennoch: Ein Testergebnis noch am selben Tag ("Same-Day-Detection") bedeutet für Produzenten einen gewaltigen Fortschritt.

Aus dem Uni-Labor zum Millionen-Funding

Die Wurzeln des Unternehmens liegen in der Julius-Maximilians-Universität Würzburg, aus der NanoStruct 2021 ausgegründet wurde. Das Gründerteam vereint dabei interdisziplinäre Kompetenzen:

Dr. Henriette Maaß (CEO) verantwortet die Unternehmensstrategie. Sie führte das Startup bereits erfolgreich durch das EU-Förderprogramm "Women TechEU", welches von Frauen geführte Hochtechnologie-Startups unterstützt.

Enno Schatz (CTO) bringt als Experte für Nano-Optik und Sensorik das tiefe technologische Know-how ein.

Kai Leibfried (CFO) steuert die Finanzierung, Geschäftsentwicklung und die kaufmännischen Prozesse.

Der Weg zur Seed-Runde wurde unter anderem durch BayStartUP geebnet: Bereits 2021 gewann das Team das Finale des Businessplan-Wettbewerbs Nordbayern. Aus diesen ersten Berührungspunkten entwickelte sich laut Carsten Rudolph, Geschäftsführer von BayStartUP, das heutige Investorenkonsortium.

Markt, Geschäftsmodell und Wettbewerb – Eine Einordnung

Mit dem frischen Kapital plant NanoStruct nun die Industrialisierung der Technologie, erste Pilotprojekte mit Kunden sowie den Ausbau des Vertriebs. Langfristig sehen die Investoren das Potenzial der Plattform-Technologie auch in weiteren kritischen Bereichen wie der Wasserversorgung, der Medizintechnik oder der Diagnostik.

StartingUp ordnet das Vorhaben wie folgt ein:

Der Markt (Pro): Das wirtschaftliche Potenzial ist enorm. Erreger-Tests am selben Tag reduzieren Lebensmittelverschwendung drastisch, da verderbliche Waren nicht mehr tagelang in Quarantäne-Lagern auf ihre Freigabe warten müssen. Zudem lassen sich millionenschwere, rufschädigende Rückrufaktionen frühzeitig abwenden.

Markteintrittsbarrieren (Contra): Die Lebensmittelindustrie ist hochgradig konservativ und streng reguliert. Ein neues Testverfahren muss nicht nur schneller, sondern zu 100 Prozent fehlerfrei arbeiten. "False-Positives" (falscher Alarm) kosten die Industrie Geld, "False-Negatives" gefährden Menschenleben. Das Vertrauen der Industrie in etablierte Standardverfahren ist historisch gewachsen und tief verankert.

Hardware-Skalierung: Im Gegensatz zu reinen Software-Geschäftsmodellen muss NanoStruct die SERS-Sensoren auf Nanotechnologie-Basis wirtschaftlich in Masse herstellbar machen. Die Skalierung von DeepTech-Hardware verschlingt erfahrungsgemäß viel Zeit und hohe Folgeinvestitionen.

Der Wettbewerb: NanoStruct tritt gegen milliardenschwere Diagnostik-Konzerne und etablierte Verfahren wie PCR-Tests an. Der entscheidende USP von NanoStruct wird es sein, zu beweisen, dass die Sensoren in der rauen industriellen Praxis tatsächlich so robust, günstig und verlässlich sind, dass sie die immensen Wechselkosten für Großkunden rechtfertigen.

Fazit

NanoStruct bringt technologisch exzellente Voraussetzungen mit und hat sich mit dem HTGF, Bayern Kapital und AUXXO sehr starke, gut vernetzte Partner gesichert. Gelingt es dem Team nun, die Technologie aus dem Würzburger Labor erfolgreich in die industrielle Realität der Lebensmittelproduktion zu übertragen, könnte das Startup tatsächlich einen neuen Goldstandard in der mikrobiologischen Qualitätskontrolle etablieren. Die wichtigste Phase – der Beweis am Kunden – beginnt jetzt.

Württemberger Medien: Nachhaltige Wachstumsstrategien

Wie die Württemberger Medien Marketing Agentur Unternehmen mit datengetriebenen Strategien und klarer Positionierung unterstützt.

Digitale Sichtbarkeit ist heute für Unternehmen kein optionaler Erfolgsfaktor mehr, sondern eine Grundvoraussetzung. Märkte werden transparenter, Wettbewerber sichtbarer und Kunden anspruchsvoller. Wer sich behaupten will, muss nicht nur präsent sein, sondern gezielt kommunizieren, analysieren und optimieren. Genau an dieser Schnittstelle zwischen Strategie, Technologie und Kommunikation setzt die wtv Online Marketing Agentur an.

Das Unternehmen hat sich darauf spezialisiert, digitale Potenziale strukturiert zu erschließen und für seine Kunden messbar zu machen. Dabei geht es nicht um kurzfristige Maßnahmen oder einzelne Kampagnen, sondern um nachhaltige Strategien, die Wachstum langfristig unterstützen.

Von der Idee zur klaren digitalen Strategie

Viele Unternehmen starten mit einzelnen Marketingmaßnahmen, ohne eine übergeordnete Strategie zu verfolgen. Social-Media-Kanäle werden aufgebaut, Anzeigen geschaltet oder Inhalte produziert – oft ohne klare Zielsetzung oder langfristige Planung. Das Ergebnis: hohe Aufwände bei begrenzter Wirkung.

Die Württemberger Medien Agentur verfolgt bewusst einen anderen Ansatz. Im Mittelpunkt steht zunächst die Analyse. Bevor Maßnahmen umgesetzt werden, geht es darum, das Unternehmen, die Zielgruppe und den Markt genau zu verstehen.

Dazu gehören unter anderem:

- die Definition klarer Ziele und Zielgruppen

- die Analyse bestehender Marketingaktivitäten

- die Bewertung von Wettbewerbern und Marktposition

- die Identifikation von Potenzialen und Schwachstellen

Auf dieser Grundlage entsteht eine individuelle Strategie, die nicht nur kurzfristige Erfolge ermöglicht, sondern langfristig trägt.

Datenbasierte Entscheidungen statt Bauchgefühl

Ein wesentlicher Unterschied moderner Online-Marketing-Ansätze liegt in der Nutzung von Daten. Während Marketing früher oft stark von Erfahrung und Intuition geprägt war, stehen heute umfangreiche Analysemöglichkeiten zur Verfügung.

Die Württemberger Medien Agentur nutzt diese Möglichkeiten gezielt, um fundierte Entscheidungen zu treffen. Daten werden nicht nur gesammelt, sondern interpretiert und in konkrete Maßnahmen übersetzt. Dadurch lassen sich Maßnahmen kontinuierlich optimieren und Budgets effizient einsetzen.

Diese Arbeitsweise bringt mehrere Vorteile mit sich:

- bessere Planbarkeit von Marketingmaßnahmen

- transparente Erfolgsmessung

- gezielte Optimierung einzelner Kanäle

- langfristige Skalierbarkeit von Strategien

Gerade für wachsende Unternehmen ist diese Transparenz ein entscheidender Faktor.

Ganzheitlicher Blick auf digitale Kanäle

Online-Marketing besteht heute aus einer Vielzahl unterschiedlicher Disziplinen. Suchmaschinenoptimierung, Performance Marketing, Content-Strategie und Social Media greifen ineinander und beeinflussen sich gegenseitig.

Die Württemberger Medien Agentur betrachtet diese Bereiche nicht isoliert, sondern als Teil eines Gesamtsystems. Ziel ist es, die einzelnen Kanäle sinnvoll miteinander zu verknüpfen und so eine konsistente Markenkommunikation zu schaffen.

Dabei werden unter anderem folgende Bereiche integriert:

- Suchmaschinenoptimierung (SEO) für nachhaltige Sichtbarkeit

- Webdesign und Website-Entwicklung für einen professionellen digitalen Auftritt

- Digitale Mitarbeitergewinnung über zielgerichtete Online-Kampagnen

- Ganzheitliche strategische Beratung zur digitalen Sichtbarkeit und Kundengewinnung

Durch diese Verzahnung entsteht ein Marketingansatz, der sowohl kurzfristige Ergebnisse als auch langfristige Wirkung ermöglicht.

Fokus auf messbare Ergebnisse

Ein zentraler Anspruch der Württemberger Medien ist die Messbarkeit von Erfolg. Marketing wird nicht als kreativer Selbstzweck verstanden, sondern als strategisches Instrument zur Erreichung konkreter Unternehmensziele.

Das bedeutet, dass jede Maßnahme klar definierten Kennzahlen zugeordnet wird. Ob Traffic, Conversion-Rate oder Umsatz – die Ergebnisse werden kontinuierlich überprüft und ausgewertet.

Diese Transparenz schafft Vertrauen und ermöglicht es Kunden, ihre Investitionen nachvollziehbar zu steuern. Gleichzeitig bildet sie die Grundlage für eine kontinuierliche Weiterentwicklung der Strategie.

Zusammenarbeit auf Augenhöhe

Neben fachlicher Expertise spielt auch die Zusammenarbeit eine entscheidende Rolle. Die Württemberger Medien Agentur versteht sich nicht als externer Dienstleister im klassischen Sinne, sondern als strategischer Partner.

Das zeigt sich vor allem in der Kommunikation. Projekte werden eng mit den Kunden abgestimmt, Entscheidungen transparent getroffen und Entwicklungen regelmäßig besprochen. Ziel ist es, gemeinsam Lösungen zu entwickeln, die zum jeweiligen Unternehmen passen.

Diese partnerschaftliche Herangehensweise bringt mehrere Vorteile:

- klare Abstimmung von Zielen und Erwartungen

- schnelle Anpassung an Veränderungen

- langfristige Zusammenarbeit statt kurzfristiger Projekte

- bessere Integration in bestehende Unternehmensstrukturen

Gerade in dynamischen Märkten ist diese Flexibilität ein wichtiger Erfolgsfaktor.

Anpassungsfähigkeit in einem dynamischen Umfeld

Die digitale Welt verändert sich kontinuierlich. Neue Plattformen entstehen, Algorithmen werden angepasst und Nutzerverhalten entwickelt sich weiter. Für Unternehmen bedeutet das, dass Strategien regelmäßig überprüft und angepasst werden müssen.

Die Württemberger Medien Agentur begegnet dieser Dynamik mit einem flexiblen Ansatz. Statt starrer Konzepte setzt sie auf kontinuierliche Optimierung und Anpassung. Entwicklungen werden frühzeitig erkannt und in die Strategie integriert.

Dadurch bleiben Kunden nicht nur wettbewerbsfähig, sondern können neue Chancen aktiv nutzen.

Branchenübergreifende Erfahrung

Ein weiterer Vorteil der Württemberger Medien Online Marketing Agentur liegt in ihrer branchenübergreifenden Erfahrung. Zu den Kunden des Unternehmens zählen lokale und regionale Dienstleister, Handwerks- und Gewerbebetriebe sowie Unternehmen aus dem Mittelstand. Dadurch entsteht ein breites Verständnis für verschiedene Geschäftsmodelle, Zielgruppen und Marktmechaniken.

Diese Vielfalt hilft dabei, funktionierende Strategien nicht isoliert zu betrachten, sondern sinnvoll auf andere Bereiche zu übertragen. Was bei einem Dienstleistungsunternehmen zu mehr Sichtbarkeit und Anfragen führt, kann, richtig angepasst, auch für Handwerks- und Gewerbebetriebe sehr gut funktionieren. Gleichzeitig entstehen durch diese Perspektivwechsel oft innovative Ansätze, die über klassische Lösungen hinausgehen.

Dennoch bleibt jede Strategie individuell. Die Württemberger Medien Agentur setzt nicht auf standardisierte Konzepte, sondern passt Maßnahmen präzise an die jeweiligen Anforderungen an. Marktumfeld, Wettbewerbssituation und Zielgruppe werden dabei ebenso berücksichtigt wie interne Strukturen und Ressourcen des Kunden.

So entsteht ein ausgewogenes Verhältnis zwischen Erfahrung und Individualität – eine Kombination, die es ermöglicht, sowohl effizient als auch kreativ zu arbeiten und nachhaltige Ergebnisse zu erzielen.

Nachhaltiges Wachstum statt kurzfristiger Erfolge

Im Zentrum der Arbeit steht ein klares Ziel: nachhaltiges Wachstum. Während viele Marketingmaßnahmen auf schnelle Ergebnisse ausgerichtet sind, verfolgt die Württemberger Medien Agentur einen langfristigen Ansatz. Es geht nicht darum, kurzfristig Aufmerksamkeit zu erzeugen, sondern darum, stabile Strukturen aufzubauen, die dauerhaft funktionieren.

Das bedeutet, dass nicht nur einzelne Kampagnen optimiert werden, sondern das gesamte digitale Fundament eines Unternehmens gestärkt wird. Sichtbarkeit in Suchmaschinen, eine klare Markenpositionierung und eine gezielte Kundenansprache werden Schritt für Schritt aufgebaut und kontinuierlich weiterentwickelt.

Dabei spielen mehrere Faktoren zusammen. Eine technisch optimierte Website sorgt für eine bessere Auffindbarkeit, ein professioneller Markenauftritt stärkt die Außenwirkung und datenbasierte Kampagnen bringen gezielt Reichweite. Durch diese Kombination entsteht ein System, das nicht von einzelnen Maßnahmen abhängig ist, sondern als Ganzes wirkt.

Ein weiterer Vorteil dieses Ansatzes liegt in der Planbarkeit. Unternehmen erhalten eine klare Perspektive, wie sich ihre Marketingaktivitäten entwickeln und welche Ergebnisse realistisch zu erwarten sind. Gleichzeitig bleibt genügend Flexibilität, um auf Veränderungen im Markt zu reagieren und neue Chancen zu nutzen.

Dieser Fokus auf langfristige Entwicklung sorgt dafür, dass Unternehmen nicht nur kurzfristig wachsen, sondern sich nachhaltig im Wettbewerb positionieren können.

Fazit

Die Anforderungen an modernes Online-Marketing sind heute komplexer denn je. Unternehmen müssen sich in einem dynamischen Umfeld behaupten, ihre Zielgruppen verstehen und gleichzeitig effizient arbeiten. Gleichzeitig steigt der Druck, Marketingmaßnahmen nicht nur umzusetzen, sondern auch deren Wirkung nachvollziehbar zu machen.

Die Württemberger Medien Marketing Agentur zeigt, wie sich diese Herausforderungen strukturiert und zielgerichtet angehen lassen. Durch die Kombination aus datenbasierter Analyse, strategischer Planung und kontinuierlicher Optimierung entstehen Lösungen, die messbare Ergebnisse liefern und gleichzeitig langfristig tragen.

Besonders hervorzuheben ist der ganzheitliche Ansatz. Statt isolierter Maßnahmen entwickelt die Agentur ein umfassendes System, in dem alle digitalen Kanäle sinnvoll miteinander verknüpft sind. Dadurch wird nicht nur kurzfristige Sichtbarkeit erzeugt, sondern eine stabile Grundlage für nachhaltiges Wachstum geschaffen.

Für Unternehmen, die ihre digitale Präsenz gezielt ausbauen und langfristig stärken möchten, bietet dieser Ansatz eine klare Orientierung. Er verbindet Strategie, Technologie und Kommunikation zu einem durchdachten Gesamtbild – und schafft damit die Voraussetzungen für kontinuierlichen Erfolg in einem sich ständig verändernden Marktumfeld.

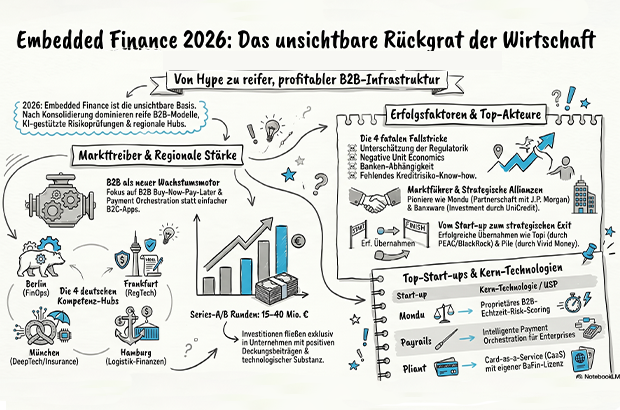

Embedded-Finance-Start-up-Report 2026

Der unsichtbare Bankensektor: Wie Embedded Finance und die dazugehörigen Start-ups die Wirtschaft des Jahres 2026 prägen.

Einst war es das große Versprechen für eine Handvoll hipper Neobanken, heute ist es das unsichtbare Rückgrat der europäischen Wirtschaft: Embedded Finance. Im Jahr 2026 wird das Marktwachstum längst nicht mehr von der fixen Idee isolierter Bank-Apps dominiert, denn jedes zukunftsorientierte Unternehmen ist mittlerweile selbst zu einem/einer Finanzdienstleister*in geworden. Ob Software-as-a-Service-Anbieter*in, Logistik-Plattform oder Marktplatz – die nahtlose Integration von Zahlungen, Krediten und Versicherungen in nicht-finanzielle Kund*innenreisen ist das neue Paradigma.

Dieser Report beleuchtet eine Branche, die den „Sturm der Konsolidierung“ überlebt hat und nun mit reifen Geschäftsmodellen und echten Profiten die Architektur der modernen Wirtschaft neu programmiert.

Vom Hype zur fundamentalen Reife

Nach den massiven Zinsanpassungen und regulatorischen Aufräumarbeiten der Jahre 2023 und 2024 zeichnet der Embedded-Finance-Markt heute ein Bild robuster Reife. Renommierte Analystenhäuser wie Bain & Company und Dealroom haben diese Entwicklung früh vorgezeichnet: Der globale Markt für Embedded-Finance-Dienstleistungen hat sich in ein Multimilliarden-Segment verwandelt, dessen europäisches Transaktionsvolumen mittlerweile signifikante Teile des digitalen B2B- und B2C-Handels stützt. Der technologische Haupttreiber dieser neuen Ära ist unbestreitbar die künstliche Intelligenz, genauer gesagt proprietäre Machine-Learning-Modelle, die Risikobewertungen in Millisekunden durchführen und Transaktionsströme dynamisch optimieren. Investor*innen honorieren diese technologische Tiefe: Wir sehen heute höchst realistische Series-A- und Series-B-Runden im Bereich von 15 bis 40 Millionen Euro für Start-ups, die nachweislich positive Deckungsbeiträge aufweisen. Es fließt wieder signifikant Kapital, doch es fließt exklusiv in Substanz und Skalierbarkeit, nicht mehr in reines Marketing.

Die neuen Treiber: B2B, Vertikalisierung und Orchestrierung

Wenn man über das Offensichtliche wie einfache White-Label-Kreditkarten hinausblickt, dominieren im Jahr 2026 drei spezifische Sub-Sektoren den Markt. Allen voran steht B2B Buy-Now-Pay-Later, eine Disziplin, die das traditionelle, schwerfällige Factoring abgelöst hat und nun direkt in B2B-Checkouts und Beschaffungsnetzwerke integriert ist. Ein weiterer massiver Treiber ist die sogenannte Payment Orchestration für vertikale SaaS-Lösungen. Hier werden komplexe, branchenspezifische Zahlungsflüsse – etwa im Handwerk oder in der Gastronomie – automatisiert im Hintergrund abgewickelt. Zuletzt etabliert sich Embedded Insurance zunehmend im Industriekontext, wo Maschinen nicht mehr nur geleast, sondern im selben Atemzug transaktionsbasiert versichert werden. Pioniere wie die Berliner Mondu oder auch europäische Schwergewichte wie Swan haben den Weg für diese hochspezialisierten Infrastruktur-Layer geebnet und gezeigt, wie tiefgreifend diese Geschäftsmodelle in die Wertschöpfungsketten der Realwirtschaft eingreifen.

Die Lektionen der BaaS-Krise

Doch dieser Reifegrad wurde teuer erkauft. Der Beinahe-Kollaps des britischen Banking-as-a-Service-Pioniers Railsr und die drastischen BaFin-Sonderprüfungen samt Wachstumsbeschränkungen bei etablierten deutschen Playern wie Solaris in den Jahren zuvor haben den Markt fundamental erschüttert. Der Traum, Finanzdienstleistungen wie einfache Legosteine zusammenzustecken, kollidierte brutal mit der harten Realität des Bankwesens.

Aus diesen gescheiterten Hoffnungen lassen sich für heutige Gründer*innen vier konkrete, fatale Fallstricke ableiten. Der erste und wichtigste ist die eklatante Unterschätzung der Regulatorik; Compliance lässt sich nicht auslagern, und Aufsichtsbehörden dulden keine agilen Versuch-und-Irrtum-Prozesse bei der Geldwäscheprävention. Der zweite Fallstrick ist die Falle der negativen Unit Economics im B2C-Sektor, wo exorbitante Kund*innenakquisitionskosten oft nur durch kontinuierliches VC-Geld gedeckt wurden. Drittens das Klumpenrisiko der Abhängigkeit von einer einzigen Partnerbank, deren Ausfall das eigene Start-up über Nacht handlungsunfähig macht. Und viertens die Fehlannahme, dass Technologie allein ausreicht; wer heute kein tiefes Verständnis für klassisches Bilanzstruktur- und Kreditrisikomanagement mitbringt, scheitert unweigerlich.

Das deutsche Netzwerk: Die Schmieden der Infrastruktur

Deutschland hat sich in dieser Konsolidierungsphase als einer der resilientesten Standorte in Europa bewiesen, getragen von vier essenziellen Hubs. Berlin verteidigt dabei seinen Status als unangefochtene Hauptstadt für FinOps und B2B-Zahlungsinfrastruktur, massiv befeuert durch die Talent-Pipelines der TU Berlin sowie das dichte Netzwerk an Serial Entrepreneurs aus der N26- und SumUp-Schule. Frankfurt am Main bildet den unverzichtbaren regulatorischen Gegenpol; hier, im Schatten von EZB und BaFin, entstehen im Umfeld des TechQuartiers und der Frankfurt School of Finance and Management jene Start-ups, die komplexe Compliance- und Treasury-Architekturen für Großbanken bauen. München dominiert den Bereich DeepTech und Embedded Insurance im industriellen B2B-Kontext, was auf die herausragende Stellung des Center for Digital Technology and Management (CDTM) und die enge Verzahnung mit der ansässigen Versicherungs- und Automobilindustrie zurückzuführen ist. Hamburg schließlich hat sich als europäischer Hotspot für Trade Finance und in Logistikketten eingebettete Finanzierungen etabliert, gestützt durch die traditionelle Stärke der Hansestadt im globalen Handel.

Investor*innen-Radar

Das Ökosystem der Geldgeber*innen hat sich im Jahr 2026 stark differenziert und professionalisiert. An der Spitze der spezialisierten VCs agieren Fonds wie FinTech Collective und Motive Ventures (hervorgegangen aus der Übernahme des Berliner VCs embedded/capital), die mit tiefem technologischen Verständnis gezielt in Infrastruktur-Layer investieren. Unter den Top-Tier Generalisten ragen Cherry Ventures, Earlybird und Point Nine heraus, die insbesondere Series-A-Runden bei überzeugenden B2B-SaaS-Modellen anführen.

Ein starker Motor sind zudem Corporate VCs und bankennahe Fonds geworden: CommerzVentures, als unabhängiger Player, treibt Themen wie Climate-Fintech massiv voran, während CVCs der Realwirtschaft wie Allianz X und Porsche Ventures strategisch in Start-ups investieren, die sich nahtlos in ihre eigenen vertikalen Ökosysteme einklinken lassen. In der kritischen Frühphase wird der Markt von einer hochgradig vernetzten Gruppe aus Business Angels angetrieben, die nicht nur erstes Kapital, sondern vor allem regulatorisches Know-how und entscheidende Bankennetzwerke einbringen

Die Top Start-ups (Must-Watch)

Für die nachfolgende Liste der Must-Watch-Unternehmen haben wir strikte Kriterien angelegt. Die Auswahl basiert auf nachgewiesener Marktrelevanz durch echte Kund*innenimplementierungen, einem hohen technologischen Reifegrad und einem diversifizierten Ansatz bei der Lösung komplexer Finanzinfrastrukturprobleme. Zudem war ein nachhaltiges Investoren-Vertrauen in den letzten zwölf Monaten ein Schlüsselfaktor. Wir beleuchten hierbei ausschließlich Start-ups mit Hauptsitz in Deutschland, deren Gründung im Jahr 2020 oder später erfolgte, um die wahre nächste Generation der Branche abzubilden.

Banxware

Das 2020 von Miriam Wohlfarth und Jens Röhrborn gegründete Banxware hat sich als Marktführer für Embedded Lending in Deutschland etabliert. Banxware bietet eine White-Label-Lösung, mit der Marktplätze und Zahlungsdienstleister*innen ihren Händler*innen Sofortkredite basierend auf historischen Umsatzdaten anbieten können. Der USP liegt in der extrem schnellen Risikoprüfung und der nahtlosen API-Integration in bestehende Plattformen. Das enorme Vertrauen der Finanzbranche in dieses Modell spiegelt sich massiv auf Investor*innenseite wider: Neben frühen Leadern wie Element Ventures (heute 13books Capital) ist insbesondere der Einstieg der Großbank UniCredit ein Ritterschlag. Die Bank führte nicht nur die Series-A-Runde an, sondern legte Mitte 2025 mit einem weiteren strategischen Millionen-Investment nach, um die europäische Expansion von Banxware gemeinsam voranzutreiben.

Pliant

Im Jahr 2020 von Malte Rau und Fabian Terner aus der Taufe gehoben, definiert Pliant den Markt für B2B-Kreditkarten und Ausgabenmanagement neu. Das B2B-SaaS-Modell kombiniert eine moderne Karteninfrastruktur mit einer tiefen API-basierten Integration in Buchhaltungs- und ERP-Systeme. Der technologische Vorsprung liegt im eigenen Card-as-a-Service-Angebot (CaaS), das anderen B2B-Plattformen den Launch eigener Kreditkartenprogramme ermöglicht. Ein entscheidender Meilenstein war hierfür der Erhalt der eigenen E-Geld-Lizenz der BaFin, die Pliant die nötige regulatorische Unabhängigkeit verleiht. Unterstützt wird Pliant von namhaften Investoren wie SBI Investment, Alstin Capital – und einem Investment des globalen Schwergewichts PayPal Ventures, das das enorme Skalierungspotenzial der Plattform bestätigt.

Mondu

Die Serial Entrepreneurs Malte Huffmann, Philipp Povel und Gil Danziger gründeten Mondu 2021 und revolutionieren damit den B2B-Zahlungsverkehr. Ihr B2B-BNPL-Modell ermöglicht es Geschäftskund*innen, online wie B2C-Kund*innen auf Rechnung oder in Raten zu kaufen, während der Händler sofort sein Geld erhält. Die Kerntechnologie ist ein proprietäres Echtzeit-Risk-Scoring für Firmenkund*innen. Finanziert wurde diese Vision anfangs von Top-Tier-Fonds wie Valar Ventures und Cherry Ventures. Der ultimative Ritterschlag erfolgte jedoch Ende 2025: Neben dem Erhalt der E-Geld-Lizenz sicherte sich Mondu eine 100-Millionen-Euro-Fazilität von J.P. Morgan Payments inklusive einer strategischen Partnerschaft, um die Buy-Now-Pay-Later-Lösung dem europäischen Kund*innen stamm der US-Großbank anzubieten.

Payrails

Gegründet 2021 von Orkhan Abdullayev, Emre Talay und Nicolas Thouzeau, löst Payrails die Herausforderung der Payment Orchestration. Das FinOps-Start-up baut ein intelligentes Betriebssystem für Zahlungen, das Transaktionen für Enterprise-Kund*innen dynamisch über verschiedene Provider routet, um Kosten zu senken und Autorisierungsraten zu maximieren. Die technologische Brillanz dieser Architektur lockte früh Schwergewichte wie Andreessen Horowitz und EQT Ventures an. Im Sommer 2025 zündete Payrails die nächste Stufe: HV Capital führte eine massive Series-A-Runde über 32 Millionen US-Dollar an, bei der auch alle Top-Tier-Altinvestoren erneut mitzogen, um die globale Expansion der Plattform endgültig zu sichern.

Finmid

Die beiden N26-Alumni Max Schertel und Alexander Talkanitsa starteten Finmid 2021 mit der Mission, jede B2B-Plattform zu einer Finanzierungsquelle zu machen. Ihr Geschäftsmodell fokussiert sich auf Embedded B2B Lending, das speziell auf die Anforderungen von Marktplätzen (wie etwa dem Partner Wolt) zugeschnitten ist – ohne dass diese Plattformen eigenes Kapital bereitstellen oder Risiken tragen müssen. Ihr USP ist die radikale Simplifizierung der B2B-Kreditvergabe durch smarte Echtzeit-Datenverknüpfungen. Angetrieben von einer wuchtigen 23-Millionen-Euro-Series-A-Runde, angeführt vom britischen Fonds Blossom Capital und dem Seed-Lead Earlybird, treibt das Start-up seine aggressive europäische Expansion unaufhaltsam voran.

Topi (Exit)

Charlotte Pallua und Estelle Merle brachten Topi 2021 an den Start, um das Hardware-as-a-Service-Modell in den B2B-Bereich zu integrieren. Über die Plattform können B2B-Kund*innen IT-Equipment flexibel mieten, wobei Topi den gesamten Prozess vom Checkout über das Refinancing bis zum Asset-Management abwickelt. Nachdem Topi mit Händler*innen wie Cyberport massiv skalierte und von Top-VCs wie Index Ventures und Creandum finanziert wurde, erfolgte im Sommer 2025 der strategische Exit: Das FinTech wurde von dem internationalen Leasing-Giganten PEAC Solutions (einem BlackRock-Portfoliounternehmen) übernommen, um das innovative B2B-Mietmodell global in dessen gewaltige Finanzierungsinfrastruktur einzugliedern.

Hakuna

Im Bereich Embedded Insurance schlägt das 2021 von Sebastian Jost, Rupert Mayer und Orhan Köroglu gegründete Hakuna neue Wege ein. Das Start-up bietet Händler*innen eine Plattform für Garantieverlängerungen und Produktschutzversicherungen, nahtlos integriert in den Online- und Offline-Checkout. Der USP ist ein völlig neu gedachtes, digitales Schadensmanagement, das die Abwicklung für Endkund*innen radikal vereinfacht. Finanziert von Top-VCs wie Earlybird und Visionaries Club, hat Hakuna mittlerweile den Sprung ins absolute Enterprise-Segment geschafft: Im Jahr 2025 integrierten Branchenriesen wie Vorwerk, STIHL und Mister Spex die Embedded-Technologie des Start-ups, um ihre eigenen, maßgeschneiderten Produktschutzprogramme europaweit zu skalieren.

Pile (Exit)

Jessica Holzbach startete Pile 2022 und pivotierte das Modell nach dem Krypto-Winter erfolgreich zu einem hochspezialisierten Treasury-Angebot für Start-ups. Die B2B-SaaS-Technologie bündelte Konten und automatisierte die Diversifikation von Einlagen zur Risikominimierung. Das Modell erregte schnell Aufmerksamkeit und führte bereits im Sommer 2024 zu einem frühen Exit: Die 2019 gegründete Berliner Neobank Vivid Money übernahm das Start-up, um das eigene Business-Banking-Angebot mit Piles Treasury-Technologie aufzurüsten – ein Paradebeispiel für die rasante Konsolidierung im FinTech-Infrastrukturmarkt.

Internationaler Ausblick & Fazit

Blickt man über die Grenzen Europas hinaus, formen sich 2026 drei gewaltige Makro-Trends, die den deutschen Markt unausweichlich verändern werden. Aus Asien schwappt die Architektur für grenzüberschreitende Echtzeit-Settlements basierend auf regulierten Stablecoins und digitalen Zentralbankwährungen heran, was das traditionelle Korrespondenzbankensystem massiv unter Druck setzt. Die USA hingegen dominieren die Entwicklung der KI-gesteuerten autonomen Finanzen, bei der das Corporate Treasury von Algorithmen gesteuert wird, die ohne menschliches Zutun Liquidität verschieben. Aus Indien lernen wir, wie Identity-as-a-Service untrennbar mit dem Zahlungsverkehr verschmilzt und Betrug nahezu ausmerzt.

Für Gründer*innen und Investor*innen im DACH-Raum bedeutet dies: Der Fokus muss radikal auf Profitabilität, wasserdichter Compliance und extrem stabiler Infrastruktur liegen. Wer heute in Embedded Finance gewinnt, baut keine bunten Apps mehr, sondern die hochkomplexen, unsichtbaren Stahlträger der digitalen Weltwirtschaft.

Boschs 200-Mio.-Euro-Wette: Kann der Industrieriese wirklich Start-up?

Bosch pumpt frische Millionen in seinen hauseigenen Venture Builder. Während andere Konzerne ihre Inkubatoren dichtmachen, will der Stuttgarter Hardware-Gigant externe Gründer*innen anlocken und tiefe Tech-Innovationen ausgründen. Ein vielversprechendes Modell für DeepTech-Start-ups – oder eine strategische Sackgasse?

Bosch Business Innovations, der Corporate Venture Builder der Bosch Gruppe, investiert in den kommenden fünf Jahren rund 200 Millionen Euro in den Aufbau neuer DeepTech-Ventures. Das ehrgeizige Ziel: Bis 2030 sollen 20 neue Start-ups außerhalb des Bosch-Kerngeschäfts aufgebaut und zur Marktreife geführt werden. Doch die Ankündigung fällt in eine Zeit, in der das Modell Corporate Venture Building (CVB) in Europa in einer tiefen Krise steckt. Konzern-Inkubatoren von SAP, Allianz oder ProSiebenSat.1 haben in der Vergangenheit längst die Segel gestrichen. Warum glaubt Bosch, die Ausnahme von der Regel zu sein?

DeepTech trifft auf Konzern-Ressourcen

Im Gegensatz zur reinen Investment-Tochter Bosch Ventures (Robert Bosch Venture Capital), die als klassischer Geldgeberin agiert, will Bosch Business Innovations Unternehmen von Grund auf selbst bauen. Zum Start konzentriert sich die Einheit auf drei hochkomplexe Bereiche: medizinische Fernüberwachung, softwaregesteuerte Fertigung und Carbon Capture.

Der Pitch an die Szene klingt verlockend: Bosch verschafft Gründungsteams einen kuratierten Zugang zu Patenten, Forschung, Testlaboren, Ingenieurwissen und globalen Lieferketten. Im Bereich Carbon Capture will man beispielsweise direkt auf bestehende Patente und technologische Vorarbeiten des Konzerns aufsetzen. Externe Gründerinnen und Gründer sollen dabei frühzeitig Verantwortung übernehmen und die Unternehmen von Anfang an aufbauen. Axel Deniz, Geschäftsführer von Bosch Business Innovations, formuliert es so: Man wolle die Technologie und die industrielle Stärke von Bosch mit der Geschwindigkeit und dem unternehmerischen Denken der Start-up-Welt verbinden.

Gegen den „CVB-Winter“

Dass Bosch genau jetzt diese Summen lockermacht, ist ein starkes Signal gegen den aktuellen „CVB-Winter“. Viele Konzern-Inkubatoren scheitern traditionell an der mangelnden Geduld des Mutterkonzerns, quälend langsamen Freigabeprozessen oder einer zu engen inhaltlichen Fesselung an das Bestandsgeschäft.

Bosch versucht, diese strukturellen Fehler zu umgehen, indem der Fokus explizit auf neuen Märkten jenseits des Kerngeschäfts liegt. Zudem öffnet sich die Einheit gezielt für die Außenwelt: Die Zusammenarbeit mit externen Venture Studios und Investor*innen soll den Zugang zu Ökosystemen verbessern und vor allem zusätzliches Kapital mobilisieren. Die Ventures sollen bis zur Investment Readiness begleitet werden und setzen dabei auf Co-Investments. Dass dieser Spin-off-Ansatz Früchte tragen kann, zeigte unlängst der erfolgreiche Exit des Corporate-Start-ups Bosch Advanced Ceramics, das aus dem Bosch-Inkubator hervorging und zum Jahreswechsel 2025/2026 an den japanischen Anlagenbauer Sintokogio verkauft wurde.

Wo liegt der Haken für Gründer*innen?

Trotz dieser Erfolge hat das Modell Tücken, die man kritisch prüfen muss. Die zentrale Frage für externe Gründer*innen lautet: Wie unabhängig kann ein Start-up wirklich agieren, wenn der entscheidende IP-Zugang (Patente, Technologie) vom Mutterkonzern kontrolliert wird?

- Geschwindigkeit vs. Konzernstruktur: Start-ups brauchen Agilität und Pivot-Bereitschaft. Konzerne hingegen neigen dazu, sich durch Vetorechte oder strategische Kontrollmechanismen abzusichern. Es besteht immer die Gefahr, dass der Corporate-Partner eher als Bremse denn als Beschleuniger wirkt.

- Die Cap-Table-Falle: Wenn Bosch das Initialkapital stellt, die Patente einbringt und die Infrastruktur liefert, bleibt für externe Gründungsteams oft nur ein Bruchteil der Anteile. Eine „schiefe“ Cap Table (Kapitalverteilung) kann jedoch spätere VC-Runden massiv erschweren, da externe Investor*innen motivierte Gründer*innen mit signifikanten Anteilen sehen wollen.

- IP-Rechte: Wem gehört die Technologie, wenn das Start-up scheitert oder sich vom Konzern lösen will? Ohne saubere und gründungsfreundliche IP-Transfer-Bedingungen wird jedes Venture zum Gefangenen seines Inkubators.

Unser Fazit: Ein Deal für Heavy-Tech, nicht für Software-Shootingstars

Für Gründer*innen im B2C- oder reinen Software-SaaS-Bereich ist das Angebot von Bosch Business Innovations uninteressant; hier genügen klassische VCs und die eigene Agilität. Wer jedoch im DeepTech-Sektor gründen will – sei es in der industriellen Dekarbonisierung oder der Medizintechnik –, steht oft vor einem enormen Hardware- und Kapital-Bottleneck. Die Entwicklungskosten sind hier astronomisch hoch.

In genau diesen „Hard Tech2-Feldern kann das Angebot von Bosch ein echter Katalysator sein. Der Zugang zu einer der weltweit größten Patentbibliotheken und industrieller Skalierung senkt das Technologierisiko enorm.

Das 200-Millionen-Euro-Commitment ist ein wichtiges Bekenntnis zum DeepTech-Standort Deutschland. Wer als Gründungsteam einsteigt, sollte sich jedoch nicht von den großen Ressourcen blenden lassen, sondern vorab knallhart über Anteile, operative Eigenständigkeit und IP-Rechte verhandeln. Nur wenn Bosch den Gründer*innen echte Beinfreiheit lässt, entstehen hier bis 2030 tatsächlich 20 flugfähige Start-ups – und nicht nur teure, konzerninterne Forschungsprojekte.

110-Mio.-Dollar-Turbo: Sereact verpasst Robotern eine Vorstellungskraft

Mit 110 Mio. Dollar frischem Kapital und „Cortex 2“ greift das Stuttgarter Start-up Sereact die USA an. Die Vision: Roboter, die physikalisch mitdenken, statt nur blind zuzugreifen.

Das 2021 gegründete Stuttgarter Start-up Sereact hat in einer aktuellen Serie-B-Finanzierungsrunde 110 Millionen US-Dollar eingesammelt. Mit dem Versprechen, Industrierobotern durch sogenannte „Weltmodelle“ eine Art situative Vorstellungskraft zu verleihen, zieht das Unternehmen erneut internationale Schwergewichte an. Doch während die Kriegskasse für die anstehende US-Expansion prall gefüllt ist, stellt sich die Frage: Kann der datengetriebene Ansatz aus dem Schwabenland die hochfinanzierte US-Konkurrenz auf ihrem Heimatmarkt wirklich ausstechen? Eine Analyse.

Millionen-Spritze für den Weltmarkt

Die Gründungsgeschichte von Sereact liest sich wie ein europäischer Tech-Traum. Ralf Gulde (CEO) und Marc Tuscher (CTO) starteten 2021 als Ausgründung der Universität Stuttgart. Was mit improvisierten Servern aus gebrauchten Grafikkarten begann, hat sich zu einem globalen Geschäft entwickelt: Nach einer Serie-A-Runde im Jahr 2025 führt nun der VC Headline die 110-Millionen-Dollar-Runde an. Beteiligt sind zudem Bullhound Capital, Daphni und Felix Capital, womit das Gesamtkapital auf über 140 Millionen US-Dollar steigt.

Der Grund für das massive Interesse liegt in der Skalierbarkeit: Mit über 200 europaweit eingesetzten Systemen gilt Sereact als einer der am häufigsten eingesetzten Anbieter von KI-Kommissionierrobotern. Die Kundenliste umfasst Größen wie BMW, Mercedes-Benz, DHL, PepsiCo und die Österreichische Post.

Cortex 2: Denken vor dem Greifen

Bisher basierte der Erfolg auf der Koppelung von Sprachmodellen und Bilderkennung. Mit der neuen Generation „Cortex 2“ geht Sereact einen Schritt weiter: Das System erweitert ein Vision-Language-Action-Modell (VLA) um ein „Weltmodell“. Anstatt nur zu reagieren, gleicht die KI Aktionen mit einem erlernten Modell der Physik ab und wählt den vielversprechendsten Weg aus.

Dieser Wechsel vom Reagieren zum Schlussfolgern ermöglicht komplexe Aufgaben, bei denen feinfühliger Kontakt entscheidend ist – etwa das Zusammenbauen von Komponenten unter Spannung oder das kratzerfreie Anbringen eines Scheibenwischers. CTO Marc Tuscher betont: „Wir bauen keine Roboter. [...] Die Hardware wird zur Massenware. Das Modell nicht.“

Der Eine-Milliarde-Picks-Vorsprung

Sereact positioniert sich als reines Software-Unternehmen, sieht seinen entscheidenden Vorteil jedoch in der Datenqualität. Ein kritischer Blick auf den Markt zeigt:

- Reale Daten vs. Simulation: Während viele Wettbewerber mit simulierten Daten trainieren, wurde Cortex 2 auf Basis von mehr als einer Milliarde realer Greifvorgänge aus der Produktion entwickelt.

- Nachgewiesene Präzision: Sereact begegnet der Skepsis gegenüber KI in der Logistik mit harten Zahlen. Laut Unternehmen erfordert nur noch jeder 53.000. Kommissioniervorgang ein menschliches Eingreifen.

- Hardware-Abhängigkeit: Trotz der Software-Stärke bleibt Sereact darauf angewiesen, dass Kunden in moderne Roboterarme und Sensorsysteme wie die hauseigene „Sereact Lens“ investieren.

Showdown in den USA

Mit der Präsentation auf der MODEX in Atlanta und der geplanten Eröffnung eines Büros in Boston in diesem Sommer bläst Sereact zum Angriff auf den US-Markt. Amerikanische Hersteller fordern produktreife KI, die sofort einsatzbereit ist.

Für die Gründer*innenszene sendet Sereact ein klares Signal: Der nächste Paradigmenwechsel der KI findet in der physischen Welt statt (Embodied AI). Der Erfolg in den USA wird davon abhängen, ob das Stuttgarter Daten-Flywheel auch gegen die gigantischen Budgets der US-Konkurrenz bestehen kann. Sereact hat den Grundstein gelegt, um das „Gehirn“ der globalen Automatisierung zu werden.

Gründer*in der Woche: Vjus.AI – Vom SEO zum GEO

Wie das 2026 von Wolfe Diener gegründete Start-up Vjus.AI den Kampf um die KI-Sichtbarkeit gewinnen will.

Die Ära der klassischen Suchmaschinenoptimierung (SEO) bekommt ernstzunehmende Konkurrenz. Wenn Nutzer*innen heute nach Produkten oder Dienstleistungen suchen, tippen sie ihre Fragen zunehmend in Dialogfenster von Sprachmodellen statt in traditionelle Suchschlitze. Genau an dieser Schnittstelle positioniert sich das neu gestartete Münchner Start-up Vjus.AI. Doch kann eine Software wirklich die „Black Box“ der generativen KI entschlüsseln – und wie nachhaltig ist das Geschäftsmodell?

Hinter der am 1. April 2026 offiziell gelaunchten Plattform steht die AtWize Business Services GmbH mit Sitz in München. Kopf des Unternehmens ist Gründer Wolfe W. Diener, der zuvor bereits in leitenden Positionen als Geschäftsführer und im Vorstand großer Softwarehäuser aktiv war. Mit dem Start von Vjus.AI vollzieht das Unternehmen nun eine strategische Erweiterung in den stark wachsenden Bereich der Answer Engine Optimization (AEO) und Generative Engine Optimization (GEO).

Vom Humankapital zur KI-Sichtbarkeit

Die Historie des Unternehmens ist dabei von einem interessanten Strategiewechsel geprägt. Ursprünglich startete AtWize 2023 mit einem Fokus auf KI-Lösungen gegen den Fachkräftemangel. Diener erklärt die Hintergründe: „Parallel hatte ich schon eine Weile an der Idee arbeitete, Unternehmen zu ermöglichen, ihre in den Ruhestand ausscheidenden Mitarbeiter strukturierter zu managen, um sie bei Bedarf für Projekte oder übergangsweise anzusprechen. Es liegt so viel Humankapital und Erfahrung brach.“ In der aktuellen wirtschaftlichen Phase sei dies jedoch kein Top-Thema gewesen, weshalb man sich zunächst auf die Software-Entwicklung für Dritte konzentriert habe.

Der eigentliche „Aha-Moment“ kam durch die tägliche Arbeit. „Im letzten Jahr haben wir dann immer mehr auch KI-Tools zur Entwicklung eingesetzt und dabei den Bedarf, sogar die Notwendigkeit erkannt, die Sichtbarkeit in KI-Modellen zu messen und zu verbessern“, so Diener. Die Dringlichkeit begründet er mit dem veränderten Nutzer*innenverhalten: „KI-Modelle geben begründete Empfehlungen zur gestellten Frage. Da sucht man nicht weiter, sondern nimmt das Ergebnis wie es ist. Wer da nicht enthalten ist, ist unsichtbar.“

Nutzer*innensimulation: Die reale Perspektive

Vjus.AI setzt auf die Simulation realer Suchanfragen. Während klassische SEO-Tools oft auf APIs zugreifen, misst diese Plattform, wie Marken in Antworten von ChatGPT, Gemini, Grok oder Perplexity tatsächlich erscheinen. Auf die Frage nach der technischen Umsetzung und der Nicht-Deterministik der KI-Modelle antwortet Diener detailliert: „Wenn Sie Ihre Sichtbarkeit bei KI-Suchen wissen wollen, dann sollte diese ja so gemessen werden, wie sie ein normaler Nutzer, der einem KI-Modell eine Frage stellt, einen Prompt eingibt, auch sieht.“ Man müsse also zunächst Prompts definieren, bei denen man gefunden werden wolle – etwa als Münchner Zahnarzt bei der Frage nach dem besten Zahnarzt vor Ort.

„Wir analysieren die Ergebnisse, die von den KI-Modelle auf die Prompts hin geliefert werden“, erklärt Diener weiter. Dabei werden Kennzahlen wie Sichtbarkeit, Ranking und Sentiments (neutrale, positive oder negative Notation) erhoben. Den Vorwurf einer verzerrenden technischen Schicht weist er zurück: „Wir sind insofern keine Zwischenschicht, sondern werten die Daten aus, die viele User auch sehen würden. Die Nicht-Deterministik führt dabei zwar zu kleinen Schwankungen, aber es entsteht insgesamt ja ein Bild über die Zeit.“

Marktchancen und der „Unfair Advantage“

Das Interesse am Markt scheint groß zu sein; bereits vor dem offiziellen Launch konnten erste Kund*innen gewonnen werden. Finanziell steht das Start-up auf eigenen Beinen: „Wir finanzieren uns komplett aus eigenen Mitteln. Und da wir schon Kunden im Entwicklungsbereich haben, konnten wir Vjus.AI früh anwenden und testen“, betont der Gründer. Mit Investor*innen habe man noch nicht gesprochen: „Jetzt erst mal machen, dann reden wir.“

Um sich gegen die großen SEO-Platzhirsche zu behaupten, setzt Diener auf vier spezifische technische Vorteile. Erstens setze man auf eine natürliche Simulation: „Unsere Art des Promptens simuliert wirklich natürliche User. Andere machen das nicht.“ Zweitens komme eine eigene Scraping-Technologie zum Einsatz. Diese erlaube eine besonders detaillierte Analyse der Ergebnisse, auch der „Nebengeräusche“ wie etwa Quellenangaben. Als dritten Punkt nennt der Gründer das analytische Prompting: Vjus.AI unterstützt nicht nur beim Erstellen von Prompts, sondern analysiert auch, wie passend diese für die Sichtbarkeitsmessung sind. Viertens biete das Improver-Modul ein Analyse-Tool, das über die Daten hinweg ermittelt, „was die Haupthebel für das Unternehmen oder die Marke ist, um die Sichtbarkeit bei KI-Suchen zu erhöhen“.

GEO als neues Standard-Tool?

Für die Zukunft sieht Diener eine klare Entwicklung. Zwar werde es in zwei Jahren wahrscheinlich immer noch die klassische Google-Suche geben, doch der Übergang sei bereits fließend, da Google zunehmend KI-Ergebnisse mitliefere. „Die Suche mit KI-Modellen wird aber die gewohnte Praxis werden“, ist sich Diener sicher.

Seine Prognose für die Branche ist deutlich: „Insofern wird SEO eher übergehen in ein GEO. Ein SEO ohne Beachtung der Optimierungen für KI-Modelle macht aus meiner Sicht aber heute schon keinen Sinn mehr.“ Das Ziel für Vjus.AI ist dabei klar gesteckt. Die größte Hürde sei es, für die Nutzer*innen den besten Mehrwert zu generieren: „Darauf liegt unser Fokus und deshalb rennen wir, so schnell wir können.“

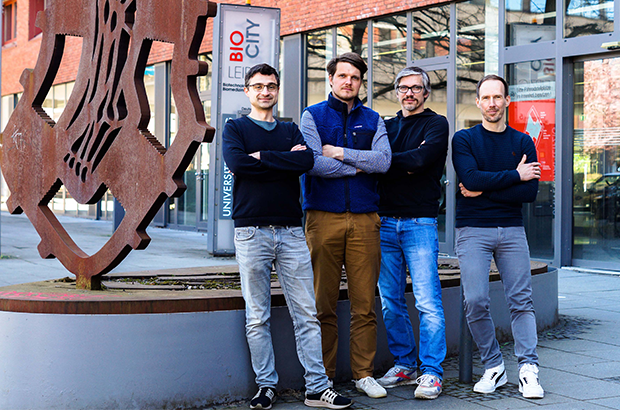

ESTER Biotech: Vom Friedhofskompost zur Plastik-Revolution

Ein Enzym vom Leipziger Südfriedhof soll das weltweite Plastikproblem lösen. Das 2025 als Uni-Spin-off gegründete Start-up ESTER Biotech verspricht, schwer recycelbares PET in Rekordzeit in seine Grundbausteine zu zerlegen. Doch auf dem Weg vom Labor in die industrielle Skalierung warten das berüchtigte „Valley of Death“ – und ein scheinbar übermächtiger Konkurrent.

Der Ursprung einer potenziellen industriellen Revolution liegt ausgerechnet auf einem Komposthaufen des Leipziger Südfriedhofs. Hier suchten Forschende der Universität Leipzig gezielt nach Mikroorganismen zur Zersetzung pflanzlicher Biopolymere und stießen auf das Enzym PHL7. Was in vielbeachteten Publikationen begann, mündete im Frühjahr 2025 in der offiziellen Ausgründung der ESTER Biotech GmbH.

Das Gründer-Quartett um die Geschäftsführer Dr. Ronny Frank und Martin Hirschfeld, den wissenschaftlichen Kopf Dr. Christian Sonnendecker (der das Enzym maßgeblich mitentdeckte) sowie den verfahrenstechnischen Leiter Madalin Ceausescu hat ein klares Ziel: das chemisch-biologische Recycling von Kunststoffen auf ein neues Level zu heben. Möglich machte diesen Schritt eine millionenschwere exist-Forschungstransfer-Förderung.

Für klassische Investor*innen sei die frühe Laborphase technologisch meist noch zu riskant, erklärt Christian Sonnendecker. Genau hier setzte das Programm an: „Der exist-Forschungstransfer hat für uns die Lücke zwischen akademischem Proof-of-Concept und einem investierbaren DeepTech-Start-up geschlossen“, betont der Gründer. „Wir konnten den Recyclingprozess vom Labormaßstab von einem Liter auf 100 Liter skalieren, neue Konzepte realisieren und das Verfahren validieren.“

Was passiert im Bioreaktor mit schmutzigem Müll?