Aktuelle Events

Mit Visual Content auf der Überholspur

Wofür und wie du automatische Bildgenerierung in deinem Start-up gewinnbringend einsetzen kannst.

Ansprechende visuelle Inhalte zu gestalten, ist für Entrepreneur*innen eine Aufgabe, die täglich viel Zeit kosten kann. Doch gerade für Start-ups ist sie besonders wichtig, da Gründer*innen ihre Marke erst noch aufbauen müssen. Automatische Bildgenerierung ermöglicht es dir, die Gestaltung von Bannern, Social-Media-Beiträgen oder Newsletter-Coupons innerhalb von Minuten zu realisieren. Ist die Bildvorlage einmal fertig, können Textelemente und Bilder schnell und hundertfach automatisch ausgetauscht werden. Wer auf diese Weise repetitive Aufgaben im Marketing digitalisiert, spart seine Ressourcen und verschafft sich einen Vorteil im Wettbewerb.

Was Bildgenerierung bedeutet und wie du sie nutzt

In diesem Artikel ist die Definition von Bild weit gefasst und beinhaltet Banner, Grafiken oder Fotos mit Beschriftung. Die ersten Programme für die automatische Generierung von Bildern kamen 2021 auf den Markt; die Entwicklung ist also noch relativ neu. Alternativ spricht man auch von automatischer Bilderzeugung oder Bildautomatisierung. Im Internet findest du die Tools unter dem Stichwort Automated Image Generation oder Image Generation Api. Doch Achtung: Die automatische Bildgenerierung ist nicht zu verwechseln mit der sogenannten Text-to-Image-AI, bei der anhand von schriftlichen Anweisungen reine KI-Bilder erzeugt werden.

Beispiel: Erzeugung von Bannern im E-Mail-Marketing

Am besten lässt sich die Technik anhand eines Beispiels erklären. Möchtest du etwa eine E-Mail-Kampagne für alle Abonnent*innen deines Newsletters starten, wäre dies ein idealer Anwendungsfall. Jede(r) Abonnent*in soll ein individuelles Banner bekommen. Fotos, Text, namentliche Ansprache des/der Kund*in – alles soll maßgeschneidert sein. Egal, ob du nun als ersten Schritt eine Vorlage aus der Vorlagenbibliothek verwendest oder selbst eine gestaltest, wie du es vielleicht von Programmen wie Canva oder Crello kennst: Jedes Bild besteht aus Schichten (Layers), wie zum Beispiel Text, Bildern oder Hintergrund. Du definierst nun diese Schichten, legst das Layout fest und kannst dann die Vorlage automatisieren.

Im Prozess der Automatisierung kann das System die Schichten dynamisch in der Vorlage „ersetzen“ und so ein neues Bild erstellen. Im Idealfall importierst du noch eine Liste mit den Namen deiner Kund*innen in das Programm, um dir die Eingabe der einzelnen Namen zu ersparen. Es wäre auch möglich, jedem Kund*innenbanner noch ein individuelles Bild zuzuordnen. So kann das System dann in Sekunden hunderte oder tausende personalisierte Banner produzieren. Du könntest also deine Kampagne noch am gleichen Tag beginnen.

Je nach Programm gibt es verschiedene Möglichkeiten der Automatisierung, die nachfolgend näher erläutert werden sollen.

Bildgenerierung über die Website

Der simple Weg ohne großen Firlefanz: Du gibst die Daten der einzelnen Schichten in ein Formular oder, wenn es viele Banner auf einmal werden sollen, in eine Tabelle ein und lädst dort die Bilder hoch. Du kannst auch vorhandene Tabellen aus Google Sheets oder Microsoft Office importieren.

Bildgenerierung über No-Code-Tools

Wer über No-Code-Tools wie Zapier oder Integrately automatisiert, braucht keine Programmiersprache zu beherrschen. Personalisierte Bilder werden direkt in No-Code-Workflows generiert.

REST-API (Programmierschnittstellen)

Wenn du Vorkenntnisse in IT hast und das entsprechende Tool flexibel in dein System integrieren willst, ist diese Art der Automatisierung die richtige Wahl. Denn wer über REST-API automatisiert, also über Schnittstellen, muss programmieren können.

URL-Parameter

Auch hier brauchst du Kenntnisse im Programmieren. Dynamische Bilder entstehen, indem du Parameter im Bildlink veränderst (Bild, Text, Farbe etc.). Der Vorteil bei dieser Methode ist, dass Verknüpfungen gut erstellt werden können. So entsteht ein automatisierter Workflow. Im Fall des Kampagnenbeispiels könntest du die Banner gleich an deine Kund*innen verschicken, indem du den Bildgenerator mit deiner E-Mail-Automatisierung verknüpfst.

Die Vorteile der Bildgenerierung für Gründer*innen

Effizienz wird durch Marketing Automatisierung gesteigert. Gerade in Early-Stage-Start-ups fehlt die Zeit für die Gestaltung von visuellem Content, weil sich viele Aufgaben auf wenige Schultern verteilen. Besonders in den sozialen Medien sind jedoch regelmäßige Beiträge unerlässlich. Weil die Tools Bilder innerhalb von Minuten variieren können und nervige repetitive Aufgaben übernehmen, werden Ressourcen freigesetzt und die Effizienz erhöht. Wer erfolgreich sein will, darf die Wirksamkeit in den Arbeitsprozessen nie aus den Augen verlieren. Automatische Bildgenerierung ist ein Mittel, um kreative, finanzielle und zeitliche Ressourcen zu schonen.

Die Handhabung ist einfach

Die Programme sind komplex, allerdings bleibt dies in der Technik verborgen. Die Nutzeroberflächen hingegen sind intuitiv, übersichtlich und leicht zu bedienen. Je nach Vorkenntnissen können die Nutzer*innen in der Regel zwischen verschiedenen Wegen der Automatisierung wählen. Die Programme verfügen außerdem über Vorlagen-Bibliotheken, sodass Designerfahrung keine Voraussetzung ist.

Fehler werden vermieden

Wer hunderte Banner nacheinander von Hand anpasst, wird früher oder später Fehler machen. Hier schlägt der Algorithmus den Menschen. Fehler, die wiederum zeitraubend sein können, entstehen erst gar nicht.

Die Automatisierung hilft der SEO

Mit den Programmen können Nutzer*innen große Mengen an Bannern generieren. Es ist also möglich, für jeden Suchbegriff das passende Bild zu erzeugen. Und was nicht unterschätzt werden darf: Einzigartige Bilder, Unique Visual Content, finden die Suchmaschinen großartig. Wenn du deine Banner und Grafiken optimal für mehr Reichweite nutzen willst, kannst du das Thema Bilder-SEO mithilfe der Lektüre des Fachartikels von Melissa Fach vertiefen. Die Autorin erklärt, wie du Alt-Tags nutzt oder Bilder für Websites so optimierst, dass bei der Ladegeschwindigkeit noch ordentlich was geht.

Bildgenerierung als Einstieg in die Automatisierung

Programme zur Bildautomatisierung lassen sich gut mit anderer Software verknüpfen, etwa mit E-Mail-Automatisierungen. Sie sind niedrigschwellig und kosten nicht viel, sodass sie einen guten Ausgangspunkt darstellen, um in die Automatisierung einzusteigen. Wer gleich mit einem „Big Bang“ alles auf einmal automatisieren will, muss viel Geld und Ressourcen in die Hand nehmen. Ein agiler Ansatz ist hier oft vorteilhafter. In der Regel kann man die Tools einen begrenzten Zeitraum testen, bevor man ein Abo abschließt. In dieser Zeit hat man dann meist ein Recht auf 25 bis 30 generierte Bilder.

Automatische Bildgenerierung kann dir einen Vorteil im Wettbewerb bringen

Auch wenn die Tools seit 2021 langsam und stetig bekannter werden, gilt: Wer jetzt einsteigt, hat immer noch die Nase vorn. Doch der Nutzen liegt nicht allein darin, anderen voraus zu sein. Start-ups können sich ihren Wettbewerbsvorteil auch dadurch verschaffen, dass sie durch die Automatisierung visuellen Content ohne Grafik- und IT-Abteilung ganz nach Bedarf gestalten.

Anwendungsbereiche der Bildautomatisierung

E-Commerce

Wer seinen Kund*innen eine große Auswahl an Produkten bietet, weiß, wie viel Arbeit die ständige Aktualisierung des Online-Katalogs bedeutet. Für Rabattaktionen wie etwa einen Season Sale müssen viele Produktbilder ausgetauscht und Preise verändert werden. Wer dieses Ersetzen von Daten manuell erledigt, braucht viel Zeit und Nerven. Das Austauschen der einzelnen „Schichten“ in den Bildern (in dem Fall zum Beispiel Preise und Produktfotos) können Unternehmer*innen der Automatisierung überlassen und gewinnen so Zeit, um sich bereits mit der neuen Kollektion zu befassen oder Kund*innen noch intensiver zu betreuen.

E-Mail-Marketing

Bildgeneratoren ermöglichen dir, personalisierte E-Cards an deine Kund*innen zu verschicken, etwa bei Abschluss eines Vertrags. Auch Coupons können damit hundertfach produziert werden, ebenso wie Header, die schnell die verstärkte Aufmerksamkeit wecken können, damit Kund*innen den Text der E-Mail auch lesen. Wenn du dem Ganzen noch die Krone aufsetzen willst, verknüpfst du die Bildautomatisierung mit einer E-Mail-Automatisierung.

Unternehmensblog

Visueller Inhalt als Wiedererkennungseffekt ist hier das Schlagwort. Viele Blogger*innen teasern ihre Texte mit Grafiken, die passend zum Thema variiert werden. Da das Schreiben allein schon viel Arbeit macht, kann es eine Entlastung sein, wenn die Teaser-Bilder dank Bildgenerierung keinen Aufwand mehr darstellen.

Soziale Medien

Die sozialen Miedien ist einer der wichtigsten Bereiche für die Anwendung automatischer Bildgenerierung. Wer auf Instagram, Twitter oder Facebook Produkte vermarkten will, muss reaktionsschnell und stets aktiv sein. Das ist in Start-ups gar nicht so leicht, wo sich die Aufgaben türmen und das Team meist noch überschaubar ist. Aber auch in größeren Unternehmen fehlt für die sozialen Medien oft die Zeit. Lassen die Kommentare jedoch nach, vergessen die Nutzer*innen möglicherweise die Marken und verlieren diese mehr und mehr ihre Sichtbarkeit im Netz. Bildautomatisierung kann Unternehmer*innen helfen, durch regelmäßige Banner-Produktion Schritt zu halten und in gleicher Zeit mehr zu posten.

Social Commerce

Laut Studien kaufen bereits zwei Milliarden Menschen weltweit über soziale Netzwerke ein, Tendenz steigend. Instagram wird das Einkaufen voraussichtlich auch in Deutschland bald noch leichter machen. In den USA läuft der sogenannte In-App-Checkout, bei dem Nutzer*innen die Plattform zum Kaufen gar nicht mehr verlassen müssen, bereits erfolgreich. Um im Wettbewerb mitzuhalten, müssen Unternehmen demnach den Social Commerce ernst nehmen. Da kommen schnell viele Banner zusammen, die an das entsprechende Format der Plattform angeglichen werden müssen. Da jedes soziale Netzwerk seine eigene Zielgruppe hat, ist auch hier die Anpassung der Banner zu berücksichtigen. Mit der Automatisierung geht das schnell und einfach.

Datenschutz und Anbieterauswahl

Bei der Auswahl des/der Entwickler*in deiner Automatisierungssoftware hast du die Wahl zwischen Firmen, deren Server auf europäischem oder auf amerikanischem Boden stehen. Je nach Sicherheitsbedürfnis entscheidest du dich also für die strengere deutsche DSGVO oder den lockereren Datenschutz in den USA. Da es um Daten deines Unternehmens und deiner Kund*innen geht, solltest du dir darüber Gedanken machen. Vielleicht entscheidet auch die Sprache des Tools darüber, welches du letztendlich auswählst. Bisher gibt es Bildgeneratoren in englischer, deutscher und französischer Sprache.

Fazit

Der Nutzen automatischer Bildgenerierung ist groß, der zeitliche und finanzielle Aufwand gering. Deshalb sollten gerade Gründer*innen hellhörig werden, denn mit Personal, Zeit und Geld müssen Start-ups gut haushalten. Vielleicht winkt schon der nächste Auftrag, für den man diese Ressourcen besser brauchen könnte. Bildautomatisierung kann daher ein niedrigschwelliger Einstieg in die Digitalisierung sein, an der heute kein Unternehmen mehr vorbeikommt. Die Tools sind einfach zu handhaben und eignen sich daher auch für jene, die mit Technik allgemein auf Kriegsfuß stehen. Andererseits kommen dank der Wahlmöglichkeiten bei der Art der Automatisierung auch Tech-Freaks auf ihre Kosten. Für die Zukunft wird es eine spannende Frage sein, inwieweit die Entwickler*innen die Programme noch mit Elementen künstlicher Intelligenz aufrüsten werden und ob dann die Qualität der Ergebnisse befriedigend sein wird.

Die Autorin Friederike Marx-Kohlstädt ist Journalistin und verantwortet die Presse- und Öffentlichkeitsarbeit beim Freiburger Softwareentwickler DynaPictures, https://dynapictures.de

Diese Artikel könnten Sie auch interessieren:

Produktivität statt Überstunden: Wie Echtzeitdaten das Finanzwesen von morgen steuern

Das KI-gestützte Fintech Embat beendet das Excel-Chaos im Treasury und macht Finanzteams mit Echtzeitdaten fit für die Zukunft.

Berlin, 28. April 2026 – Es ist ein bekanntes Bild in den Finanz- und Treasury-Abteilungen des deutschen Mittelstands: Wenn der Monatsabschluss naht oder Ad-hoc-Berichte für die Geschäftsführung benötigt werden, bleiben die Schreibtischlampen bis spät in die Nacht an. Die manuelle Zusammenführung von Daten aus unterschiedlichen Bankportalen und historisch gewachsenen Excel-Listen kostet nicht nur Nerven, sondern vor allem wertvolle Zeit.

Das schnell wachsende Fintech Embat tritt an, um genau diesen Engpass aufzulösen. André Reimers, Head of DACH, treibt diese Mission im deutschsprachigen Raum als Gesicht des Unternehmens voran. Seine Kernüberzeugung: Wer heute noch regelmäßig Überstunden machen muss, um finanzielle Transparenz zu schaffen, leidet nicht unter mangelnder Einsatzbereitschaft – er leidet unter einem strukturellen Datenproblem.

Beeindruckendes Wachstum durch das Lösen echter Pain Points

Dass der Schmerz in den Finanzabteilungen groß und der Bedarf an modernen Lösungen riesig ist, belegen die Zahlen, mit denen Embat den europäischen Markt aufrollt. Mit einem starken Kundenwachstum im deutschen Markt von über 250 Prozent im vergangenen Jahr und mittlerweile mehr als 400 mittelständischen und großen Unternehmenskunden weltweit hat sich das Fintech als fester Player etabliert. Das stetig wachsende Transaktionsvolumen von 250 Millionen Euro zeigt deutlich: Der Wechsel von fehleranfälligen Tabellen zu automatisierten Cloud-Lösungen ist in vollem Gange.

Der Weg aus der Excel-Falle

Mit seiner Technologie nimmt Embat den Kampf gegen ineffiziente Prozesse im Treasury auf. Anstatt hochqualifizierte Mitarbeiter mit repetitiver Datenpflege zu binden, automatisiert das System die Konsolidierung aller relevanten Finanzdaten.

„Die Erwartungshaltung, dass komplexe Finanzanalysen zwingend mit langen Abenden im Büro einhergehen müssen, ist schlichtweg nicht mehr zeitgemäß“, erklärt André Reimers. „Wenn Cashflow, Liquidität und Runways per Knopfdruck in Echtzeit abrufbar sind, ändert sich die gesamte Arbeitsdynamik. Finanzteams können aus dem reaktiven Modus heraustreten und sich auf die strategische Steuerung des Unternehmens konzentrieren.“

Hohe Innovationskraft trifft auf lokales DACH-Verständnis

Embat profitiert von einer enormen Innovationsgeschwindigkeit und Agilität, auf der die starke technologische Basis des Unternehmens beruht. Wie diese passgenau auf die spezifischen Bedürfnisse des deutschen Marktes übersetzt wird und für eine hohe lokale Marktpräsenz sorgt, zeigt André Reimers an den Standorten in München und Berlin.

Von diesen beiden Standorten aus steuert André Reimers das DACH-Geschäft und stellt das tiefe Verständnis für die komplexen Strukturen und hohen Sicherheitsbedürfnisse des deutschen Mittelstands sicher. Das Team zeigt dabei, wie moderne, dezentrale Zusammenarbeit erfolgreich funktioniert. Das Vertrauen der stetig wachsenden deutschen Kundenbasis fußt dabei auf dieser geballten lokalen Expertise gepaart mit der unerschütterlichen Zuverlässigkeit der Systeme.

Führen durch Resultate, nicht durch Anwesenheit

Die Botschaft an die Finanzwelt ist klar: Moderne Führung, hohe Produktivität und Skalierbarkeit erfordern keine starren Kontrollmechanismen oder endlosen Arbeitstage. Sie erfordern radikale Datentransparenz und die richtigen digitalen Werkzeuge. Wenn die Daten in Echtzeit fließen, sinkt die Fehlerquote, die Entscheidungsgeschwindigkeit steigt – und die systembedingten Überstunden im Treasury gehören endgültig der Vergangenheit an.

Über Embat:

Embat ist ein KI-gestütztes FinTech mit Schwerpunkt auf Treasury-Management, das es mittelständischen Unternehmen und Großkonzernen ermöglicht, ihre Finanzprozesse in Echtzeit zu zentralisieren. Gegründet von Antonio Berga und Carlos Serrano – ehemaligen J.P. Morgan-Managern mit umfassender Erfahrung im Corporate Banking – sowie Tomás Gil, dem ehemaligen CTO von Fintonic, entstand die Plattform mit der Mission, die Finanzabteilung zu digitalisieren. Die klare Prämisse dabei: Technologie von Finanzexperten für Finanzexperten.

Durch seine hybride Konnektivität lässt sich Embat in über 15.000 Banken und führende ERP-Systeme integrieren und beseitigt so jegliche Datenfragmentierung. Das wichtigste Alleinstellungsmerkmal ist TellMe, ein „Agentic Treasury Analyst“ (autonomer KI-Analyst), der Cashflow-Muster erkennt, komplexe Kontenabstimmungen automatisiert und strategische Entscheidungen zur Optimierung der Liquidität vorschlägt.

Mit Niederlassungen in Madrid, London, Berlin und München definiert Embat die Zukunft des Corporate Finance neu.

„Wir scheitern nicht an der Technologie, sondern an der Kommerzialisierung“

Warum wandern Europas DeepTech-Gründer*innen ab? Wie viel Schuld trägt das europäische Ökosystem daran – und wie viel die Gründer*innen selbst? Im Interview: Dr. Martin Schilling, Ex-N26-COO und CEO von Deep Tech Momentum, über fehlendes Risikokapital, mangelnde Traktion und den schweren Weg zur Skalierung.

Deutschland und Europa sind starke Quellen für DeepTech-Innovationen – aus Universitäten, Forschungseinrichtungen, Patenten und technischer Domänenexpertise. Dass wir hier in der Spitzenliga spielen, belegen Studien wie das European Innovation Scoreboard, des Europäischen Patentamts und der Max-Planck-Gesellschaft regelmäßig. Dennoch stehen wir vor einem massiven Problem: Es mangelt nicht an Innovationen selbst, sondern an ihrer Kommerzialisierung. Im Vergleich zu den USA, wo Investor*innen häufig früher und mit höherer Risikobereitschaft auf große technologische Wetten setzen, finden europäische Start-ups zu spät Kund*innen, Traktion und risikofreudiges Kapital. Weil Kommerzialisierung, Industrialisierung und Wachstum hierzulande oft langsamer verlaufen, entsteht für viele Gründer*innen ein struktureller Druck, Kapital und Skalierung in den USA zu suchen.

Einer, der diese Lücke an der Schnittstelle von Gründer*innen, Kapital und Unternehmenskunden aus erster Hand beobachtet, ist Dr. Martin Schilling. Der ehemalige COO von N26 und Managing Director von Techstars Berlin ist heute Co-Founder und CEO von Deep Tech Momentum (DTM). DTM ist Europas führende Plattform für DeepTech und AI Innovation, findet vom 20. bis 21. Mai 2026 in Berlin statt und bringt Unternehmen als potenzielle Kund*innen, DeepTech-Start-ups als Anbieter*innen und Investor*innen aktiv zusammen.

Wir wollten von Martin Schilling erfahren: Wie viel Schuld trägt das europäische Ökosystem an der geschilderten Misere – und wie viel die Gründer*innen selbst?

StartingUp: Martin, du stellst die These auf, es mangele in Europa nicht an DeepTech-Innovationen, sondern an der Kommerzialisierung. Machen wir es uns damit nicht zu einfach? Müssten wir nicht ehrlicherweise auch über die katastrophal langsamen IP-Transfer-Prozesse an deutschen Universitäten, überregulierte Märkte und den Fachkräftemangel sprechen, die Start-ups schon abwürgen, bevor sie überhaupt etwas kommerzialisieren können?

Martin Schilling: Ich glaube, wir dürfen uns hier nichts vormachen. Natürlich haben wir in Europa strukturelle Probleme wie langsame IP-Transfer-Prozesse, fragmentierte Märkte, Regulierung, Fachkräftemangel. Das alles ist real und bremst viele Entwicklungen aus. Aber diese Faktoren erklären nicht vollständig, warum wir trotz exzellenter Forschung so selten globale Kategorie-Gewinner hervorbringen.

Der entscheidende Punkt ist aus meiner Sicht ein anderer: In Europa denken wir Technologie oft zu lange aus der Perspektive der Forschung und zu spät aus der Perspektive des Marktes. In den USA wird viel früher gefragt: Wer zahlt dafür? Wie schnell kommen wir in echte Deployment-Szenarien? In Europa fragen wir zu lange, ob die Technologie perfekt ist. Das führt dazu, dass viele DeepTech-Start-ups zu spät mit echten Kunden interagieren, zu spät lernen und zu spät Traktion aufbauen. Die strukturellen Themen sind ein Teil des Problems. Aber die Art, wie wir Unternehmen bauen und die fehlende frühe Kommerzialisierungslogik sind aus meiner Sicht größere Hebel.

StartingUp: Du hast als COO bei N26 massives Wachstum miterlebt – ein B2C-FinTech mit einer App. DeepTech bedeutet aber oft jahrelange Forschung, Hardware-Entwicklung, Patente und B2B-Sales-Zyklen, die ewig dauern. Wie viel B2C-Wachstums-Mindset lässt sich überhaupt auf hochkomplexe DeepTech-Unternehmen übertragen, ohne an der Realität zu scheitern?

Martin Schilling: Man kann DeepTech nicht wie ein B2C-FinTech skalieren. Das wäre naiv. Die Zyklen sind länger, die Kapitalintensität höher, und die technische Unsicherheit ist real. Aber das heißt nicht, dass man auf ein Wachstums-Mindset verzichten kann. Was übertragbar ist, sind nicht die Taktiken, sondern die Prinzipien: Geschwindigkeit im Lernen, radikale Kundenorientierung und der Anspruch, früh zu skalieren und nicht erst, wenn alles perfekt ist.

Was ich oft sehe ist, dass DeepTech-Teams jahrelang die Technologie optimieren, bevor sie ernsthaft in den Markt gehen. In dieser Zeit verlieren sie wertvolle Iterationen. Die besten Teams denken von Anfang an in Dual Tracks: Technologie entwickeln und parallel kommerzielle Hypothesen testen. Das bedeutet nicht, dass man Hardware-Zyklen beschleunigen kann. Aber man kann sehr wohl beschleunigen, wie schnell man versteht, wo echter Bedarf ist und wie Zahlungsbereitschaft entsteht.

StartingUp: Ein ständiger Kritikpunkt ist, dass der Zugang zu mutigem Kapital in Europa langsamer funktioniert als in den USA. Aber VCs sind keine Wohlfahrtsverbände, sie rechnen Risiko und Rendite durch. Müssen wir nicht vielleicht zugeben, dass viele europäische DeepTech-Cases geschäftlich einfach nicht attraktiv oder zu schlecht gepitcht sind, um ein amerikanisches Risikoprofil anzuziehen?

Martin Schilling: Es ist zu einfach, alles auf fehlendes Kapital zu schieben. Ja, die USA haben mehr Kapital und mehr Risikoappetit. Aber Kapital folgt am Ende immer überzeugenden Geschichten und vor allem überzeugender Traktion. Was ich in Europa oft sehe: Technologisch brillante Teams, aber schwache Positionierung, unklare Go-to-Market-Strategien und zu wenig Fokus auf kommerzielle Meilensteine. Viele Pitches sind technisch beeindruckend, aber beantworten nicht die entscheidende Frage, warum aus etwas ein erfolgreiches Geschäftsmodell wird. Das heißt nicht, dass es kein strukturelles Kapitalproblem gibt. Das gibt es. Aber wir müssen genauso ehrlich sagen: Ein Teil des Problems liegt in der Art, wie wir DeepTech-Unternehmen bauen und erzählen.

StartingUp: Du beobachtest somit, dass deutsche Start-ups oft nicht an der Technologie, sondern an Marktanbindung und Traktion scheitern. Wenn die Technologie exzellent ist, scheitert es dann am Menschlichen? Wie oft erlebst du, dass brillante Forschende aus Eitelkeit nicht loslassen können und sich weigern, den CEO-Posten an erfahrene Business- und Sales-Profis abzugeben?

Martin Schilling: Das Thema gibt es, aber ich würde es differenzierter sehen. DeepTech entsteht oft aus wissenschaftlicher Exzellenz. Und diese Gründer*innen bringen etwas extrem Wertvolles mit: tiefes Verständnis, langfristiges Denken und eine hohe technische Vision. Die Herausforderung entsteht, wenn diese Stärken nicht durch kommerzielle Kompetenz ergänzt werden. Ich erlebe weniger ein klassisches „Ego-Problem“, sondern eher ein Rollenproblem, denn viele Gründer*innen haben nie gelernt, was es bedeutet, ein Unternehmen zu skalieren. Das gilt insbesondere im B2B-Kontext. Die besten Teams lösen das sehr pragmatisch. Sie bauen früh komplementäre Führungsteams mit starkem Sales-, Operations- und Marktverständnis auf. Ob das dann ein externer CEO ist oder nicht, ist zweitrangig. Entscheidend ist, dass die Organisation die Fähigkeiten hat, nicht nur Technologie zu entwickeln, sondern sie auch zu verkaufen.

StartingUp: Um Start-ups, Corporates und Investor*innen zusammenzubringen, veranstaltest du im Mai das Event Deep Tech Momentum in Berlin. Aber ganz ehrlich: Es gibt in Europa und Deutschland bereits hunderte Start-up-Konferenzen, Summits und Matchmaking-Events. Warum sollte ausgerechnet ein weiterer Marktplatz das tiefgreifende strukturelle Problem lösen, dass die deutsche Industrie oft schlichtweg zu risikoavers ist, um bei jungen Start-ups einzukaufen?

Martin Schilling: Ich stimme dir zu. Es mangelt nicht an Events in Europa, wir haben eher zu viele davon. Der Unterschied bei Deep Tech Momentum ist, dass wir kein klassisches Konferenzformat sind, sondern ein Marktplatz. Was heißt das konkret? Wir bringen nicht einfach Leute zusammen, sondern orchestrieren konkrete Interaktionen zwischen Start-ups, Corporates und Investor*innen. Dabei verfolgen wir das klare Ziel, Deals, Partnerschaften und Deployment zu schaffen.

Bei Deep Tech Momentum kommen über 3.000 Senior Entscheider*innen zusammen. Über den Marktplatz wurden bereits mehr als 500 Millionen Euro an Investitionen und hunderte Partnerschaften angestoßen. Unser Ziel bis 2030 ist es, 100 Milliarden Euro zusätzliche DeepTech-Investitionen zu mobilisieren und 10.000 Partnerschaften zwischen Start-ups und Industrie zu ermöglichen.

Ein Beispiel ist unser Guardian Program. Dort bringen wir die Top 300 Senior Innovation Leaders aus führenden Unternehmen gezielt mit vorqualifizierten DeepTech-Start-ups zusammen, also mit Unternehmen, die echte Budgets, konkrete Anwendungsfälle und Entscheidungsmandate mitbringen. Damit packen wir aus meiner Sicht das Kernproblem Europas an: Wir verschaffen Zugang zu ersten Kunden und realen Anwendungen.

StartingUp: Durch langsames Wachstum entsteht ein Druck auf Gründer*innen, in die USA auszuweichen. Dort lockt der Markt gezielt mit Milliarden-Subventionen und schnellem Kapital. Was entgegnest du einem DeepTech-Gründer, der heute zu dir sagt: „Herr Schilling, Europa ist nett für die Forschung, aber um ein Einhorn zu bauen, muss ich sofort in die USA?“

Martin Schilling: Ich würde niemandem pauschal davon abraten, in die USA zu gehen. Für viele Modelle ist das absolut sinnvoll, gerade wenn es um Kapital und Marktskalierung geht. Aber ich würde zwei Dinge entgegnen. Erstens: Europa ist kein schlechter Ort, um ein DeepTech-Unternehmen zu bauen. Wir haben exzellente Forschung, starke Industriepartner und zunehmend auch Kapital. Zweitens – und wichtiger: Der Engpass ist oft nicht der Standort, sondern die Geschwindigkeit, mit der man Kommerzialisierung erreicht. Wenn ein Start-up es schafft, früh echte Kunden zu gewinnen, Piloten zu fahren und Umsatz aufzubauen, dann wird Kapital folgen, auch in Europa. Mit Deep Tech Momentum möchten wir den Weg von Technologie zur Anwendung beschleunigen. Denn es geht nicht um Europa vs. USA. Es geht darum, ob ein Unternehmen es schafft, aus Technologie ein funktionierendes Geschäft zu machen.

Danke, Martin Schilling, für die spannenden Insights

Das Interview führte StartingUp-Chefredakteur Hans Luthardt

Durchatmen in der KI-Ära: HR-Tech-Start-up Regulate sammelt 1,4 Mio. Euro ein

Ein neues B2B-Tool will die mentale Fitness in Unternehmen messbar machen. Hinter dem 2024 von Peter van Woerkum und Paul Laechelin gegründeten Münchner Breathwork-Start-up Regulate stehen prominente Szene-Köpfe. Doch kann eine App das grundlegende Problem struktureller Überlastung lösen?

Die Arbeitswelt verdichtet sich zusehends. Inmitten geopolitischer und wirtschaftlicher Unsicherheiten wird künstliche Intelligenz (KI) in alle Lebensbereiche integriert, was das Arbeitstempo spürbar beschleunigt. In diesem Spannungsfeld positioniert sich das Münchner Start-up Regulate. Das Unternehmen hat nun eine Seed-Finanzierungsrunde in Höhe von 1,4 Millionen Euro abgeschlossen.

Angeführt wird die Runde vom Impact-Investor 4impact.vc. Zu den Business Angels zählen zudem bekannte Namen der deutschen Startup-Szene, darunter Hanno Renner (Co-Founder & CEO, Personio), Mike Wax (Co-Founder, Forto), Marlena Hien (Co-Founder, Bears with Benefits) und Felix Haas (10x Group, Bits & Pretzels, IDnow).

Die Köpfe und die Historie

Hinter Regulate stehen CEO Peter van Woerkum und Paul Laechelin, die das Unternehmen im Jahr 2024 gründeten.

- Peter van Woerkum: Der Gründer ist ein zertifizierter Breathwork- und Executive-Coach, der auf über zehn Jahre Erfahrung in der C-Level-Beratung zurückblickt.

- Paul Laechelin: Als ehemaliger Product Lead für die BMW App bringt er die notwendige technische Expertise mit, um das Produkt für den Enterprise-Einsatz zu skalieren.

- Wissenschaftliches Fundament: Die inhaltliche Entwicklung der App erfolgte in Partnerschaft mit Prof. Dr. Hottenrott von der Martin-Luther-Universität Halle-Wittenberg. Die angebotenen Methoden basieren zudem auf Forschungen der Harvard Medical School und Stanford Medicine.

Das Geschäftsmodell: Präzision statt Gießkanne

Regulate grenzt sich bewusst von herkömmlichen Wellness-Apps ab. Anstatt allgemeine Meditationsübungen bereitzustellen, die in firmeninternen Benefit-Portalen oft ungenutzt bleiben, zielt die Plattform darauf ab, im passenden Moment die richtige Intervention anzubieten.

- Contextual Intelligence: Die App verknüpft sich mit Wearables und den digitalen Arbeitssystemen der Nutzer.

- On-Demand-Tool: Durch das Auslesen physiologischer Signale und die Analyse der Arbeitsstruktur werden personalisierte Atemübungen (Dauer: 90 Sekunden bis 60 Minuten) vorgeschlagen. Dies kann ein Fokus-Protokoll vor einem wichtigen Meeting oder eine Übung zur Beruhigung nach einer intensiven Diskussion sein.

- HR-Dashboard: Arbeitgeber erhalten aggregierte Dashboards, die HR- und Führungsteams Einblicke in Nutzungsmuster und Team-Resilienz geben, ohne die Privatsphäre des Einzelnen zu kompromittieren.

Das Geschäftsmodell stößt auf Resonanz: Innerhalb von weniger als zwölf Monaten wurden über 50.000 Sessions in der App absolviert. Die Enterprise-Pipeline umfasst ein potenzielles Volumen von über 9 Millionen Euro Annual Recurring Revenue (ARR). Zu den Kunden gehören unter anderem die Raiffeisen Bank International, Personio und Vattenfall. Mit dem neuen Kapital will Regulate das Wachstum beschleunigen, die Produktfunktionen vertiefen, Live-Formate ausbauen und europaweit expandieren.

Der Markt: Wachstumsdruck trifft auf Regulatorik

Regulate agiert in einem enormen Markt. Der globale Bereich für Stressmanagement am Arbeitsplatz wurde im Jahr 2023 auf 10,6 Milliarden US-Dollar geschätzt und wächst jährlich um 7,7 Prozent.

- Laut dem „State of the Global Workplace“ Report 2026 von Gallup gibt weltweit nur jede(r) dritte Arbeitnehmer*in an, am Arbeitsplatz zu „florieren“.

- Diese mangelnde Mitarbeiter*innenbindung kostet die Weltwirtschaft schätzungsweise 10 Billionen US-Dollar an ungenutzter Produktivität pro Jahr.

- Die Weltgesundheitsorganisation (WHO) bezifferte in einer Analyse von 2024 die zusätzlichen Kosten durch arbeitsplatzbedingte Angstzustände und Depressionen auf jährlich 1 Billion US-Dollar durch Produktionsausfälle.

Während in den USA vor allem direkte Gesundheitskosten die Arbeitgeberprogramme antreiben, wird der europäische Markt maßgeblich durch rechtliche Verpflichtungen geprägt. Die EU-Richtlinie zur Nachhaltigkeitsberichterstattung (CSRD) – seit Januar 2024 in Kraft – und die EU-Richtlinie zur Vereinbarkeit von Beruf und Privatleben zwingen Unternehmen zu mehr Transparenz und Berichterstattung beim Wohlbefinden der Belegschaft.

Unsere Einordnung: Heilsbringer oder Symptombekämpfung?

Aus Gründer*innen- und Investor*innensicht ist die Positionierung von Regulate strategisch klug. Der B2C-Markt für Achtsamkeit ist hochkompetitiv. Durch den strikten Fokus auf den B2B-Enterprise-Bereich und die nahtlose Integration in den Arbeitsalltag schafft Regulate eine starke Differenzierung. Besonders clever ist die Nutzung der europäischen CSRD-Richtlinie als Vertriebshebel: Unternehmen müssen Wohlbefinden reporten, Regulate liefert das passende aggregierte Dashboard direkt mit.

Trotzdem muss sich das Modell kritischen Fragen stellen:

- Symptombehandlung vs. Ursachenbekämpfung: Eine App kann strukturelle Überlastung durch Personalmangel, fehlendes Management oder toxische Unternehmenskulturen nicht lösen. Es besteht die Gefahr des „Wellbeing-Washings“, bei dem Unternehmen die Verantwortung für Stressbewältigung auf das Individuum abwälzen. CEO Peter van Woerkum betont zwar, dass die Plattform „keine weitere Stressquelle“ hinzufügen soll, doch in stark verdichteten Arbeitsumgebungen kann selbst ein technischer Push-Reminder zur Atemübung als belastend wahrgenommen werden.

- Datenschutz und Vertrauen: Die Koppelung physiologischer Wearable-Daten an ein vom Arbeitgeber finanziertes Dashboard betritt eine sensible Linie. Auch wenn Regulate betont, die Daten streng zu aggregieren, ist die Auswertung von Stressparametern am Arbeitsplatz – gerade in DACH-Unternehmen mit starken Betriebsräten – ein Terrain, das maximales Vertrauen der Belegschaft erfordert.

Fazit

Regulate hat erkannt, dass Corporate Health in Zukunft messbar und direkt in den Arbeitsalltag integriert sein muss. Kann das Start-up beweisen, dass seine Dashboards den Unternehmen helfen, Arbeitsbedingungen datenbasiert und strukturell zu verbessern, steht dem europaweiten Rollout kaum etwas im Wege.

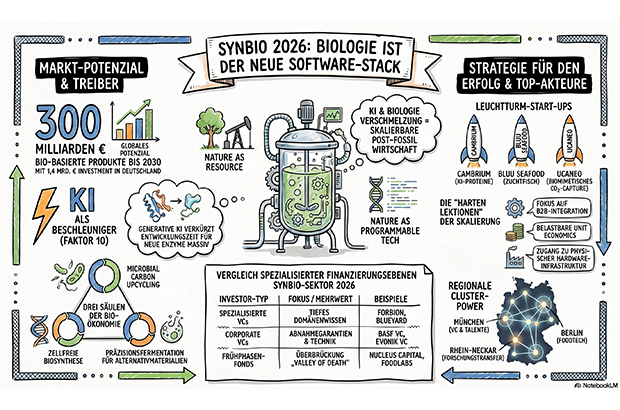

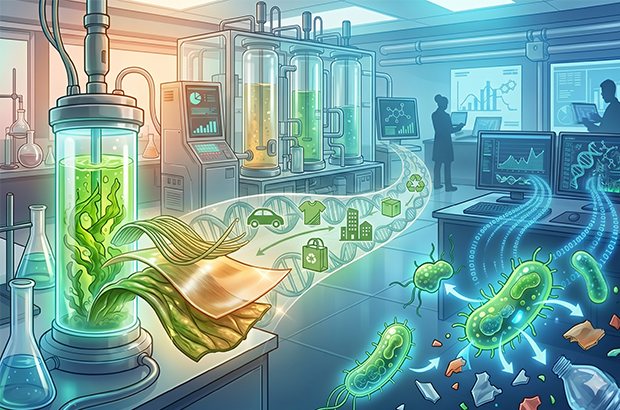

SynBio-Start-up-Report 2026

Biologie ist der neue Code: Wie Synthetische Biologie (SynBio) die Industrie neu programmiert und welche Start-ups dabei hierzulande federführend sind.

Die Vision einer post-fossilen Wirtschaft ist im Jahr 2026 keine bloße Utopie mehr, sondern eine präzise Ingenieursleistung. Wir erleben den Moment, in dem die Natur von einer Ressource, die wir ausbeuten, zu einer Technologie wird, die wir programmieren. In den Laboren der Republik entstehen heute Lösungen für die größten Versorgungskrisen unserer Zeit. Der Aufstieg der Synthetischen Biologie (SynBio) markiert den Übergang vom Zeitalter der Petrochemie in das Zeitalter der Biomanufaktur – eine Transformation, die so tiefgreifend ist wie die industrielle Revolution, jedoch mit der Geschwindigkeit der digitalen Transformation erfolgt.

Wenn Bits auf Atome treffen

Der SynBio-Markt ist 2026 in eine Phase der industriellen Skalierung eingetreten. Aktuelle Analysen der KfW sowie Branchenberichte von BCG beziffern das globale Marktpotenzial für bio-basierte Produkte bis Ende des Jahrzehnts auf über 300 Milliarden Euro. Allein in Deutschland ist das Investitionsvolumen in DeepTech-BioTech-Start-ups im vergangenen Geschäftsjahr laut Bitkom-Daten auf einen Rekordwert von 1,4 Milliarden Euro gestiegen. Der entscheidende technologische Katalysator ist die Verschmelzung von Generativer KI und Biologie. Dank Modellen, die Proteinfaltungen präziser vorhersagen können, als es je ein menschlicher Forscher vermochte, wurde die Entwicklungszeit für neue Enzyme um den Faktor zehn verkürzt. Die Biologie wird damit endgültig zum „Software-Stack“, bei dem Design-Build-Test-Learn-Zyklen in digitalisierten Bio-Gießereien automatisiert ablaufen.

Jenseits der Petrischale: Die Treiber der Bio-Ökonomie

Drei spezifische Sub-Sektoren dominieren in diesem Jahr die Agenda der Investor*innen. An erster Stelle steht die zellfreie Biosynthese, bei der komplexe Moleküle ohne den Einsatz lebender Zellen produziert werden, was die Skalierbarkeit massiv erhöht. Pioniere wie das US-Unternehmen Solugen haben hier den Weg geebnet, doch deutsche Akteure ziehen in der Effizienz der Bioreaktor-Steuerung nach. Ein zweiter massiver Treiber ist das Microbial Carbon Upcycling: Mikroben werden so programmiert, dass sie industrielles CO2 direkt in hochwertige Proteine oder Kunststoffe umwandeln. Hier verschmelzen Klimaschutz und Produktion zu einer Einheit. Drittens sehen wir den Siegeszug der Biomanufaktur bei Alternativmaterialien – sei es durch Biomasse-Fermentation für Lederersatz aus Myzel oder durch echte Präzisionsfermentation, bei der etablierte Akteure wie die bayrische AMSilk zeigen, dass programmierte Spinnenseide-Proteine bereits in Serie gehen können. Die Lieferkette der Mode- und Automobilindustrie wird durch diese Biopolymere radikal dekarbonisiert.

Die harten Lektionen der Skalierung

Der Weg zum Erfolg war jedoch von schmerzhaften Rückschlägen gepflastert. Der prominente Crash des einstigen Branchenlieblings Amyris im Jahr 2023 wirkt bis heute als warnendes Beispiel nach. Das Unternehmen scheiterte trotz Milliardenbewertung an der Komplexität der vertikalen Integration und dem Versuch, gleichzeitig Technologieplattform und B2C-Marke zu sein. Für heutige Gründer*innen haben sich daraus vier fatale Fallstricke herauskristallisiert, die über Sieg oder Niederlage entscheiden. Erstens: Die Ignoranz gegenüber den Unit Economics. Ein Produkt, das im 5-Liter-Maßstab funktioniert, muss im 50.000-Liter-Kessel nicht zwangsläufig profitabel sein. Zweitens: Das „Regulatorik-Vakuum“. Wer die EU-Novel-Food-Verordnungen oder GVO-Richtlinien nicht von Tag eins an in die Produktentwicklung einplant, riskiert Jahre des Stillstands. Drittens: Die Fokussierung auf den Endkonsument*innen statt auf B2B-Integration. Der wahre Hebel liegt in der Lizenzierung von Prozessen an die Industrie. Viertens: Die Unterschätzung der Hardware-Komponente. SynBio ist kein reines Software-Business; ohne Zugang zu physischer Infrastruktur bleibt jede Innovation im Labor gefangen.

Deutschlands Bio-Cluster

Deutschland hat sich im internationalen Vergleich als einer der stärksten Hubs für SynBio etabliert, getrieben durch eine einzigartige Verzahnung von Spitzenforschung und industrieller Basis. In München und dem angeschlossenen IZB Martinsried konzentriert sich die größte Dichte an Venture Capital und Talenten, eng flankiert durch die Exzellenz-Cluster der TU München. Berlin hat sich durch spezialisierte Inkubatoren wie den ProVeg Incubator, Atlantic Food Labs (FoodLabs) und den Science Park Berlin-Buch zum absoluten Zentrum für FoodTech und zelluläre Landwirtschaft entwickelt. Ein weiterer Hotspot ist das Rhein-Neckar-Delta rund um Heidelberg, wo das European Molecular Biology Laboratory (EMBL) und der BioRN-Cluster eine Brücke zwischen Grundlagenforschung und Marktreife schlagen. Aachen punktet mit der RWTH und einer starken Fokussierung auf Bio-Verfahrenstechnik, während der Raum Darmstadt/Frankfurt durch die Nähe zu Giganten wie Merck und die TU Darmstadt als Kraftzentrum für die industrielle Bioproduktion gilt.

Investor*innen-Radar

Die Finanzierungslandschaft hat sich spezialisiert. Wir unterscheiden im Jahr 2026 vier Ebenen der Kapitalgeber*innen. Die spezialisierten VCs wie Forbion, BlueYard Capital oder Sofinnova Partners bringen das notwendige tiefe Domänenwissen mit. Auf der zweiten Ebene stehen Top-Tier Generalisten wie HV Capital und Earlybird, die SynBio zunehmend als Teil ihrer Dekarbonisierungs-Strategie begreifen. Besonders kritisch für die Skalierung sind die Corporate VCs der Industrie, allen voran BASF Venture Capital und Evonik Venture Capital, die nicht nur Geld, sondern auch Abnahmegarantien und technisches Know-how bieten. In der Frühphase bewegen zudem spezialisierte Mikro-Fonds wie Nucleus Capital oder erfahrene ClimateTech-Angels den Markt, oft organisiert in Syndikaten, die das „Valley of Death“ zwischen Labor und Prototyp überbrücken

Die Top-Start-ups: Unsere Must-Watch-Liste 2026

Für die folgende Auswahl der Start-ups haben wir Unternehmen analysiert, die nach 2019 in Deutschland gegründet wurden. Die Auswahlkriterien basieren auf der technologischen Tiefe (IP-Portfolio), dem Reifegrad der Pilotierung, der Validierung durch renommierte Investoren sowie dem Potenzial, bestehende industrielle Lieferketten systemisch zu verändern. Diversität in Gründungsteams und die Skalierbarkeit der zugrunde liegenden Bio-Plattform waren weitere entscheidende Faktoren.

- Cambrium (Berlin, gegründet 2020): Das Team um Dr. Mitchell Duffy nutzt eine KI-gestützte Designplattform, um neuartige Proteine mit molekularen Funktionen zu entwickeln, die in der Natur so nicht vorkommen. Ihr Fokus liegt auf der Kosmetik- und Textilindustrie, wo sie petrochemische Inhaltsstoffe durch bio-designte Alternativen ersetzen. Mit massiven Finanzierungsrunden, angeführt von Tech-Schwergewichten wie Essential Capital und dem Google-KI-Fonds Gradient Ventures, gilt Cambrium als Leuchtturm für eine neue Generation von Biomaterial-Zulieferern, die aus digitalem Code physische Hochleistungsprodukte erschaffen.

- Bluu Seafood (Berlin, gegründet 2020): Gegründet von Dr. Sebastian Rakers und Simon Fabich, ist Bluu einer der führenden europäischen Akteure im Bereich kultivierter Fisch. Durch die Kultivierung echter Fischzellen im Bioreaktor adressieren sie die Überfischung der Meere. Nach signifikanten Investments durch Lead-Investor Sparkfood sowie LBBW VC und Delivery Hero Ventures steht das Unternehmen kurz vor der ersten Marktzulassung in Singapur und den USA.

- Colipi (Hamburg, gegründet 2022): Das Spin-off der TU Hamburg, geführt von Maximilian Webers, nutzt eine patentierte Gasfermentationstechnologie, um CO2 in nachhaltige Öle und Lipide umzuwandeln. Der USP von Colipi ist die Nutzung von industriellen Abgasströmen als Rohstoff, was die Produktion extrem kosteneffizient macht. Sie konnten sich frühzeitig die Unterstützung von Top-Investoren wie dem High-Tech Gründerfonds (HTGF) und dem Innovationsstarter Fonds Hamburg sichern.

- Kynda (Jelmstorf, gegründet 2019): Ursprünglich als Keen 4 Greens von Daniel MacGowan-von Holstein und Franziskus Schnabel gegründet, bietet Kynda Plug-and-Play-Fermentationssysteme für die Lebensmittelindustrie an. Als B2B-Technologiepartner stellen sie modulare Bioreaktoren und Pilzkulturen bereit, mit denen Hersteller ihre eigenen Produktionsabfälle direkt vor Ort kostengünstig in Mykoproteine umwandeln können. Eine kürzliche 3-Millionen-Euro-Seed-Finanzierung – angeführt vom VC EnjoyVenture und massiv flankiert durch ein strategisches Investment des Geflügel-Giganten PHW-Gruppe – unterstreicht das enorme Skalierungspotenzial dieses Kreislauf-Modells.

- Nosh.bio (Berlin, gegründet 2022): Das Team um Tim Fronzek nutzt Pilzbiomasse als funktionalen Inhaltsstoff für die Lebensmittelindustrie, um Clean-Label-Produkte ohne Zusatzstoffe zu ermöglichen. Der technologische Vorsprung von Nosh.bio liegt in der Geschwindigkeit des Fermentationsprozesses. Frühphasen-Finanzierungen durch Earlybird unterstreichen das hohe Vertrauen in das Skalierungspotenzial.

- Ucaneo (Berlin, gegründet 2022): Das Team um Florian Tiller und Carla Glassl beweist, dass Synthetische Biologie auch beim Direct Air Capture (DAC) den Unterschied macht. Statt energieintensiver chemischer Filter nutzt Ucaneo eine biomimetische Technologie: Sie setzen das Enzym Carboanhydrase ein – eines der schnellsten Enzyme der Natur –, um CO2 bei Raumtemperatur direkt aus der Umgebungsluft zu binden. Mit starken Frühphasen-Finanzierungen durch DeepTech-Fonds wie Nucleus Capital und der US-amerikanischen Grantham Foundation baut Ucaneo derzeit in Berlin-Marienfelde ihre erste industrielle Testanlage auf.

- Insempra (München, gegründet 2021): Das Team um Gründer Jens Klein hat sich zum Ziel gesetzt, die massive Abhängigkeit der globalen Lieferketten von der Petrochemie zu beenden. Über ihre B2B-Technologieplattform nutzen sie Präzisionsfermentation, um maßgeschneiderte Inhaltsstoffe für die Kosmetik-, Lebensmittel- und Textilbranche quasi zu programmieren – von bio-basierten Lipiden und Aromen bis hin zu neuartigen Proteinfasern. Eine hochkarätige Finanzierungsrunde, angeführt von europäischen DeepTech-Schwergewichten wie EQT Ventures und BlueYard Capital, unterstreicht den Anspruch von Insempra, ein globaler industrieller Zulieferer der nächsten Generation zu werden.

Ausblick & Fazit: Der globale Wettlauf

Der Blick über den Tellerrand zeigt: Wir stehen in einem globalen Systemwettbewerb. In den USA treibt die per Executive Order erlassene „National Biotechnology and Biomanufacturing Initiative“ Milliardeninvestitionen in die heimische Infrastruktur, flankiert von Pionieren, die dort und in Frankreich (wie Biomemory) bereits an der Verschmelzung von SynBio und DNA-Datenspeicherung arbeiten. In Asien, insbesondere in China und Singapur, werden derweil regulatorische Hürden in Rekordzeit abgebaut, um die Marktführerschaft bei der Biomanufaktur zu übernehmen. Flankiert wird dies von Hubs wie Israel, die mit massivem VC-Kapital den globalen Markt für kultivierte Proteine dominieren wollen.

Das Fazit für das Jahr 2026: Biologie ist die Infrastruktur der Zukunft. Für Gründer*innen bedeutet dies, dass die Zeit der reinen Plattform-Versprechen vorbei ist; gefragt sind konkrete Produkte und belastbare Unit Economics. Für Investor*innen bietet SynBio die seltene Chance, echte „Impact-Rendite“ zu erzielen, indem sie Industrien transformieren, die über Jahrzehnte festgefahren waren. Wer heute den Code der Natur versteht und skalieren kann, wird die Welt von morgen nicht nur verstehen, sondern neu bauen.

Gründer*in der Woche: Brotrausch – Premium-Teig im recycelten Messbecher

Backen ohne Frust: Wie Brotrausch mit smarten Premium-Mischungen im recycelbaren Messbecher den hart umkämpften DIY-Brotmarkt aufmischen will.

Hinter der 2022 ins Leben gerufenen Marke Brotrausch, die 2023 offiziell an den Start ging, steht heute die Bremer Brot GmbH. Das Unternehmen hat die Marke im Jahr 2025 durch einen Asset Deal übernommen. An der Spitze des Start-ups steht ein Gründer, dessen Wurzeln weit abseits des klassischen Bäckerhandwerks liegen. Philipp Herrnberger, einst in der Sportvermarktung bei Werder Bremen tätig, gründete nicht aus einer entspannten Laune heraus, sondern aus gesundheitlichen Gründen. Nach dem Konsum von herkömmlichem Industrie-Brot kämpfte er immer wieder mit Beschwerden. Sein Antrieb: Ein bekömmliches, transparentes Brot ohne Zusatzstoffe zu kreieren, das man ohne Vorwissen einfach selbst backen kann.

Der Sprung aus der Agenturwelt in die Food-Szene war unkonventionell, doch genau das habe dem Team geholfen, „Dinge anders zu denken“, erinnert sich Herrnberger. In der ersten Phase finanzierte sich das anfänglich fünfköpfige Gesellschafterteam komplett aus eigenen Mitteln. Der Mix aus Bäckermeister, Kaufmann und Kreativen brachte dabei entscheidende Vorteile: „Wir konnten uns voll auf Produkt und Marke konzentrieren, ohne von Anfang an von externen Erwartungen getrieben zu sein“, erklärt der Geschäftsführer. Dennoch räumt er rückblickend offen ein, dass der Bootstrapping-Ansatz an seine Grenzen stieß. „Unter dem Strich muss man sagen, dass wir es ohne externe Investoren nicht geschafft haben“, resümiert Herrnberger über den rettenden Asset-Deal und Neustart im Sommer 2025.

Premium-Teig im recycelten Messbecher

Das Geschäftsmodell hebt sich bewusst vom preissensiblen Massenmarkt ab und richtet sich an all jene, denen im Post-Corona-Alltag schlichtweg die Zeit für aufwändige Sauerteig-Experimente fehlt. Hier setzt das Start-up mit absoluter Convenience an: Die neun natürlichen Brotmischungen erfordern laut Hersteller keinerlei Backerfahrung, kommen gänzlich ohne Küchenmaschine aus und beschränken sich auf rund zehn Minuten aktive Arbeitszeit. Die Zutaten für die „Made in Germany“-Strategie stammen aus kontrolliertem, regionalem Anbau.

Raffiniert und praktisch zugleich ist die Verpackungslösung: Die Mischungen ruhen in einem PET-Becher, der direkt als exakter Messbecher für die benötigte Wasserzugabe dient. Doch gerade ein Plastikbecher weckt in der nachhaltigkeitsgetriebenen Zielgruppe oft Skepsis. Herrnberger verteidigt die Entscheidung leidenschaftlich und verweist auf das rigorose Ausschlussverfahren in der Produktentwicklung. „Kraftpapiertüten sehen offensichtlich nachhaltig aus, wenn sie aber wie für uns beschichtet wären, können sie nur noch verbrannt werden“, kontert der Gründer. Dies sei überhaupt nicht im Sinne der Ressourcenschonung. Stattdessen setzt Brotrausch auf einen vollständig aus recyceltem PET bestehenden Becher einer deutschen Firma. Da die Pappbanderole raffiniert „einschnappt“ und nicht geklebt wird, seien beide Komponenten zu 100 Prozent wiederrecycelbar. Damit sei die Marke auch fit für zukünftige rechtliche Verpackungsvorschriften.

Smarte Nischen und margenstarkes Upselling

Anstatt den oft verlustreichen Preiskampf im regulären Supermarktregal zu suchen, etabliert sich Brotrausch konsequent als D2C-Marke im Premium-Segment. Eine reguläre Brotbackmischung schlägt mit 5,99 Euro zu Buche – eine echte Ansage für ein Produkt, in das die Kundschaft noch Strom, Wasser und Arbeitszeit investieren muss.

„Auf den ersten Blick wirkt der Preis natürlich hoch, vor allem, wenn man ihn rein mit Mehl vergleicht“, gibt Herrnberger zu bedenken. Dieser Vergleich greife jedoch zu kurz. „Wir verkaufen kein Rohprodukt, sondern ein durchdachtes Gesamterlebnis“, betont er und verweist auf die raffinierten Rezepturen und Prozesse, die zu einem Resultat führen, „das viele so zuhause sonst nicht hinbekommen würden“. Die Preisakzeptanz misst das Unternehmen primär über das Feedback und das Kaufverhalten. Als Kund*innen begannen, nicht nur ein zweites Mal zu bestellen, sondern direkt größere Pakete und mehrere Sorten in den Warenkorb legten, wusste das Team: Der Markt akzeptiert den Premium-Aufschlag. Zudem stellt Herrnberger klar: „Im Übrigen kostet das Backen im heimischen und relativ neuen Backofen keine 25 Cent.“

Aus den regulären Supermärkten hat sich Brotrausch mittlerweile bewusst zurückgezogen, da der Kampf um die Regale dort stark über den Preis diktiert wird. „Wir fokussieren uns nun auf Genusspartner wie Weinhändler, Hofläden oder Feinkosthändler, bei denen die Preise hochwertiger Produkte eher akzeptiert werden“, erklärt der Geschäftsführer den strategischen Kurswechsel.

Um die ambitionierte Preisgestaltung zu rechtfertigen, inszeniert das Start-up seine Produkte gezielt als Lifestyle-Upgrade – etwa für das autarke Vanlife beim Camping, als Mitbringsel zum Grillen oder für den Osterbrunch. Flankiert wird das Kernsortiment durch ein lukratives Upselling-Portfolio, das von stilvollen Geschenkboxen für knapp 30 Euro bis hin zu speziellen Baguette-Backblechen, Fruchtaufstrichen und Stullensalzen reicht. Diese Zusatzartikel seien laut Herrnberger zwar nicht essenziell für das Überleben des Unternehmens, da das Brotbacken der Mittelpunkt bleibe, sie seien aber entscheidend für das Wachstum. „Im E-Commerce geht es um den durchschnittlichen Warenkorb und die Retention“, analysiert der Gründer. Das Zusatzsortiment mache das „Erlebnis Brot“ noch intensiver. Der Umsatzanteil dieser lukrativen Extras liegt aktuell bei knapp 15 Prozent.

Die Gretchenfrage der Kund*innenbindung

Dieser strategische Ansatz sichert gesunde Margen und entzieht die Marke geschickt der Vergleichbarkeit mit Discountern. Dennoch bleibt eine große Herausforderung: Der Markt für DIY-Lebensmittel ist durch starke Bio-Traditionsmarken massiv umkämpft. Die größte Hürde besteht darin, die Wiederkaufsrate auf einem profitablen Niveau zu halten. Denn wenn die stylische Mischung primär als originelles Präsent zum Vatertag verschenkt wird, fehlen dem Unternehmen am Ende die wiederkehrenden Alltagsumsätze.

Einen aggressiven Rollout in den stationären Einzelhandel schließt Herrnberger vorerst aus. Dies sei nur mit hohen Investitionen machbar und berge das Risiko, zu einem „One-Hit-Wonder“ zu verkommen. Die Devise lautet stattdessen: „Wir wollen gesund wachsen, um profitabel zu werden.“ Die Geschenkboxen spielen in dieser Strategie eine überraschende Doppelrolle. Sie treffen nicht nur den Zeitgeist, sondern fungieren als cleverer Akquise-Kanal. „Wir erreichen dadurch Menschen, die uns vielleicht noch nicht kennen und unmittelbar mit der Marke, der Qualität und dem Erlebnis in Berührung kommen“, freut sich Herrnberger. Auf diese Weise spare man sich enorme Kund*innenakquisitionskosten. Zudem entwickle sich das Geschenke-Segment zunehmend zu einem echten Profitcenter im B2B-Bereich – etwa wenn Immobilienmakler die Boxen zur Hausübergabe als modernes „Brot und Salz“-Präsent nutzen.

Trotz der starken Nischen-Performance ist klar: Brotrausch muss langfristig beweisen, dass das Premium-Brot aus dem Becher nicht nur an Feiertagen verschenkt wird, sondern den dauerhaften Sprung in die alltägliche Frühstücksroutine der Konsument*innen schafft.

Primogene: 4,1 Mio. Euro für den Muttermilch-Code – Deep-Tech-Innovation oder riskantes Unterfangen?

Das Leipziger BioTech-Start-up Primogene hat eine Seed-Finanzierung in Höhe von 4,1 Mio. Euro eingesammelt, um komplexe bioaktive Moleküle im industriellen Maßstab auf den Markt zu bringen.

Während die Unternehmenskommunikation den Durchbruch einer neuen Plattformtechnologie feiert, zeigt ein genauerer Blick auf den globalen Markt für humane Milcholigosaccharide (HMOs) ein Haifischbecken voller multinationaler Konzerne. Eine kritische Analyse des Geschäftsmodells, der Gründer*innen und des Wettbewerbs.

DeepTech Made in Leipzig

Hinter Primogene stehen Dr.-Ing. Reza Mahour (CEO), Valerian Grote und Linda Karger (COO), die das Unternehmen 2023 in Leipzig gründeten. Die Zusammensetzung des Teams vereint technologische und wissenschaftliche Expertise, um die ehrgeizige Vision einer industriellen Enzym-Produktion umzusetzen. Die aktuelle, 4,1 Millionen Euro starke Seed-Runde wird vom High-Tech Gründerfonds (HTGF) angeführt. Zum Investoren-Konsortium gehören außerdem der Technologiegründerfonds Sachsen (TGFS), better ventures, die Sächsische Beteiligungsgesellschaft (SBG), die Golzern Holding GmbH, die FS Life Science Investment GmbH sowie Dr. Marc Struhalla, Gründer und CEO der c-LEcta GmbH. Der Kapitaleinsatz ist klar definiert: Die neuen Mittel fließen in den Ausbau des IP-Portfolios, die Erweiterung der Produktionskapazitäten in Leipzig und in strategische Partnerschaften.

Das Modell im Stresstest: Die Kostenfalle der Enzyme

Primogene hat eine enzymatische Plattformtechnologie entwickelt, um Inhaltsstoffe zu produzieren, die identisch zu natürlichen Molekülen sind – nachhaltig und kosteneffizient. Im Zentrum stehen dabei komplexe humane Milcholigosaccharide (HMOs) wie Disialyllacto-N-Tetraose (DSLNT) und Difucosyllacto-N-Tetraose I (LNDFH I). Laut Primogene verursachen etablierte fermentative Herstellungsverfahren erhebliche Kosten und stoßen bei der Produktion derartiger hochkomplexer Moleküle an ihre Grenzen.

Der Lackmustest: Die Prämisse, dass enzymatische Verfahren in der Massenproduktion überlegen sind, birgt in der Praxis massive Hürden. Die Entwicklung und wirtschaftliche Produktion der benötigten Enzyme selbst ist extrem kapitalintensiv. Dass das Start-up den gesamten Prozess – von der Enzymentwicklung über die Produktion und Biotransformation bis zur Aufreinigung – komplett am eigenen Unternehmensstandort in Leipzig abbilden will, ist ein ambitionierter, aber riskanter Schritt. Der Aufbau eigener Produktionsanlagen für komplexe BioTech-Prozesse führt oft zu einer enorm hohen Kapitalverbrennungsrate (Burn Rate).

Erste kommerzielle Meilensteine dämpfen dieses Risiko jedoch: Erste Inhaltsstoffe für Kosmetikprodukte wurden mit Kooperationspartnern entwickelt und sind bereits kommerziell erhältlich. Auch pharmazeutische Rohstoffe befinden sich aktuell im Test bei Kund*innen. Zudem erforscht das Unternehmen in Zusammenarbeit mit dem Fraunhofer-Institut für Zelltherapie und Immunologie (IZI) in Leipzig das Potenzial seiner Inhaltsstoffe zur Prävention von Infektionskrankheiten.

Im Haifischbecken: Auf Kollisionskurs mit den Lebensmittel-Riesen

Der Zielmarkt ist hochattraktiv: Der globale HMO-Markt wächst jährlich um etwa 18 bis 20 Prozent, und über 65 Prozent der im Jahr 2023 neu eingeführten Säuglingsnahrungsprodukte enthielten mindestens ein HMO. Neben der Säuglingsernährung bedient Primogene auch Märkte wie die Darmgesundheit bei Erwachsenen, die Gedächtnisverbesserung im Alter sowie funktionale Inhaltsstoffe für Körperpflege und pharmazeutische Rohstoffe.

Das Leipziger Team trifft in der Nahrungsmittelindustrie jedoch auf einen extrem konsolidierten Markt, der von Milliarden-Konzernen dominiert wird. Einer der größten B2B-Zulieferer für Säuglingsnahrung weltweit ist DSM-Firmenich (mit der übernommenen Sparte Glycom), der den Markt durch gigantische Größenvorteile (Economies of Scale) in der Fermentation beherrscht. Auch Chr. Hansen (Jennewein), ein Pionier in der mikrobiellen HMO-Synthese, stellt mit seiner extrem tiefen Integration bei Lebensmittelriesen einen massiven Konkurrenten dar. Auf der Abnehmerseite agieren Endkonsument*innen-Giganten und Branchenführer wie Nestlé und Abbott, bei denen für einen neuen Zulieferer von Inhaltsstoffen extrem hohe regulatorische und volumenbasierte Hürden bestehen.

Primogenes strategische Nische: Ein Preiskampf bei einfach strukturierten Standard-HMOs gegen die großen Fermentations-Player wäre für ein Start-up kaum zu gewinnen. Primogenes entscheidender Wettbewerbsvorteil liegt jedoch in der Komplexität. Die industrielle Produktion von Molekülen wie DSLNT – das laut klinischen Studien signifikante gesundheitliche Vorteile speziell für Frühgeborene bietet – war bislang schlicht nicht möglich. Wenn Primogene hier durch sein starkes Patentportfolio die technologische Lücke schließt, umgeht das Unternehmen den harten Konkurrenzkampf im Massenmarkt.

Unser Fazit: Hohes Risiko, riesiger Hebel

Primogene ist kein schlankes Software-Projekt, sondern waschechtes DeepTech. Das bedeutet: Hohe regulatorische Hürden, langer Atem in der Forschung und massive Kapitalanforderungen. Die Seed-Finanzierung in Höhe von 4,1 Millionen Euro ist ein starker Vertrauensbeweis erfahrener Investoren, wird für den Anlagenbau und die Skalierung der Leipziger Produktion auf Dauer jedoch kaum ausreichen. Primogene muss nun rasch beweisen, dass die enzymatische Synthese nicht nur technologisch überlegen, sondern auch unter realen industriellen Kostendrücken skalierbar ist. Gelingt dieser Proof of Concept, hält das Start-up den Schlüssel zu einer neuen Generation komplexer, bioaktiver Moleküle in der Hand.

Bootstrapping im LegalTech: Wie cleverklagen den Arbeitsrechtsmarkt aufmischt – und wo die Grenzen des Modells liegen.

LegalTech-Start-ups versprechen den niederschwelligen Zugang zum Recht. Das 2020 von Fabian Beulke und Lucas Rößler gegründete cleverklagen fokussiert sich dabei auf das Arbeitsrecht und will Arbeitnehmer*innen bei Kündigungen sowie Abfindungen unterstützen. Die Besonderheit: Das Gründer-Duo wächst im Gegensatz zu vielen Wettbewerber*innen profitabel und das gänzlich ohne Investor*innen. Doch in einem hart umkämpften Markt stellt sich die Frage, wie nachhaltig das provisionsbasierte Geschäftsmodell und der technologische Vorsprung wirklich sind.

Der Markt für verbraucherorientiertes LegalTech (B2C) hat in den vergangenen Jahren in Deutschland stark an Fahrt aufgenommen. Im Zentrum stehen oft standardisierbare Massenverfahren – von Fluggastrechten über Mietminderungen bis hin zum Arbeitsrecht. In letzterem Segment positioniert sich cleverklagen.

Bootstrapping in einem teuren Markt

Gegründet wurde die Plattform im Jahr 2020 von den beiden Rechtsanwälten Fabian Beulke und Lucas Rößler. Die Idee entstand in ihrer gemeinsamen Zeit bei der renommierten Kanzlei Hausfeld LLP, wo sie maßgeblich in die Betreuung großer Sammelklagen involviert waren. Diese Erfahrung inspirierte das Duo zu einem Ansatz, den sie selbst als eine Art „Robin Hood Litigation“ beschreiben: Sie wollen die strukturellen Nachteile von Arbeitnehmer*innen gegenüber ressourcenstarken Unternehmen ausgleichen. Dabei positioniert sich das Start-up bewusst als moderne Alternative zur klassischen Kanzlei.

Bemerkenswert für die Start-up-Szene: cleverklagen wächst seit der Gründung profitabel und verzichtet dabei vollständig auf externes Kapital. Das ist mutig. Denn im B2C-Arbeitsrecht haben Kund*innen einen extrem niedrigen Lifetime Value – man wird idealerweise nur einmal gekündigt –, während die Akquisekosten via Google Ads enorm sind. Wie stemmt man das gegen VC-finanzierte Konkurrenz?

„Wir haben bewusst klein angefangen“, blickt Lucas Rößler zurück. „Gerade beim Bootstrapping kommt es darauf an, extrem effizient und genau zu arbeiten. Denn wenn das Geld knapp ist, kann man sich nur wenige Fehler leisten“, erinnert er sich an die harte Anfangsphase, in der das Duo nahezu alles selbst übernehmen musste. Fehlerverzeihlich ist das B2C-Arbeitsrecht bis heute nicht: Wer im Google-Ads-Wettbewerb gegen VC-finanzierte Player antritt, braucht Nerven aus Stahl – und, wie Rößler anmerkt, „einen starken Sales-Funnel, von der Anzeige bis zur Conversion“. Neben dieser technischen Präzision brauche es laut dem Gründer aber auch „sehr viel Liebe fürs Detail und ein gutes Verständnis, was die Kund*innen von einem erwarten“. Ob sich ein(e) einzelne(r) Mandant*in rechne, müsse man in der Summe betrachten. Dank erfahrener Anwält*innen sei man meist erfolgreich, was dem Unternehmen heute eine finanzielle Stabilität gebe, die in der Anfangsphase gefehlt habe.

Prozesskostenfinanzierung statt Stundenlohn

Die Geschäftsidee verknüpft digitale Prozessabläufe mit der Betreuung durch echte Jurist*innen. Eine eigens entwickelte Software soll Arbeitsabläufe vereinfachen und dem Team mehr Raum für die Mandant*innenbetreuung geben. Das Kernstück ist jedoch das finanzielle Modell, das einer klassischen Prozesskostenfinanzierung entspricht: Es gibt kein Vorkostenrisiko und im Falle einer Niederlage entstehen den Arbeitnehmer*innen keine Kosten. Verfügen die Kund*innen über keine Rechtsschutzversicherung, finanziert cleverklagen den Prozess vor. Im Gegenzug wird eine Provision fällig, die als Teil der zusätzlich ausgehandelten Abfindung beschrieben wird.

Doch wie hoch ist diese Erfolgsprovision genau? „Unsere Erfolgsprovision ist bewusst nicht einheitlich festgelegt, sondern hängt immer vom jeweiligen Fall ab“, erklärt Fabian Beulke. Man berücksichtige das Verlustrisiko, die übernommenen Anwaltskosten und die realistische Abfindungshöhe. „Durchschnittlich kann man sagen, dass unser Erfolgshonorar bei knappen 30 Prozent liegt“, präzisiert Beulke. Stehe eine sehr hohe Abfindung im Raum, könne die Provision auch deutlich darunter fallen – bei hohem Risiko aber auch entsprechend steigen.

Während sich das Duo bei der Erfolgsquote auskunftsfreudig zeigt – derzeit schließe man über 90 Prozent der Fälle erfolgreich ab und wachse jährlich um rund 50 Prozent –, mauern die beiden bei der Frage nach den genauen Finanzen. „Zu konkreten Umsatzzielen äußern wir uns allerdings nicht“, wiegelt Beulke ab.

Das „Rosinenpickerei“-Dilemma

Das Modell der Prozessfinanzierung ist lukrativ, steht bei Kritikerinnen aber oft unter dem Verdacht des sogenannten Cherry-Pickings. Der Vorwurf lautet, Anbieter*innen würden durch Algorithmen rigoros vorfiltern und nur die fast risikolosen Fälle annehmen, während komplexe oder wirtschaftlich kleinere Schicksale durchs Raster fallen.

Lucas Rößler wehrt sich vehement gegen diese Darstellung: „Diese Kritik können wir so nicht bestätigen. Unsere Ablehnungsquote ist sehr niedrig, denn wir wollen so vielen Menschen wie möglich helfen.“ Zwar bleibt Rößler eine exakte Prozentzahl bei der Ablehnungsquote schuldig, verspricht aber: „Uns ist es ganz egal, ob unser(e) Mandant*in Mini-Jobber*in oder eine hochbezahlte Führungskraft ist. Auch komplexere oder risikoreichere Fälle schließen wir nicht aus.“ Abgelehnt werde laut Rößler nur bei Anfragen, die den eigenen moralischen Werten widersprechen – oder „wenn kein Anspruch oder Verhandlungshebel gegen den bzw. die Arbeitgeberin vorliegt“. Robin Hood agiert im LegalTech-Markt eben auch mit wirtschaftlichem Kalkül.

Proprietäre Software vs. Standard-KI

Cleverklagen betont medial gern den Einsatz eigener Tech- und KI-Lösungen. Doch in Zeiten, in denen sich standardisierte juristische Branchen-KIs rasant entwickeln, wird eine eigene Fallbearbeitungs-Software zunehmend zum reinen Hygienefaktor und verliert als unüberwindbarer Wettbewerbsvorteil an Strahlkraft.

Wo genau zieht das Start-up also die technische Grenze zwischen Automatisierung und anwaltlichem Handwerk? „Künstliche Intelligenz soll unsere Anwält*innen in erster Linie bei repetitiven und administrativen Aufgaben unterstützen“, ordnet Fabian Beulke ein. Es gehe vor allem um Fristen- und Aufgabenmanagement, Terminplanung oder die Dokumentenverwaltung. Dabei setze man auf hohe Datenschutzstandards: Die hauseigene KI laufe ausschließlich auf eigenen Servern, gänzlich ohne externe Datenverbindungen. Zudem durchkämme die KI laufend die Akten für Konsistenz-Checks. Ein pragmatischer statt revolutionärer Ansatz, wie Beulke unumwunden zugibt: „Das ist wichtig, damit bei der Vielzahl laufender Fälle nichts daneben geht.“

Bei der juristischen Kernarbeit zieht Beulke jedoch eine klare rote Linie: „Uns ist wichtig, dass eine Entscheidung nie von der KI getroffen wird. Diese Verantwortung liegt ausschließlich bei unseren Anwält*innen.“ Gerade das Arbeitsrecht sei viel Verhandlungssache, die oft mündlich in persönlichen Gesprächen oder vor Gericht geklärt werde. „Es braucht ein starkes Verhandlungsgeschick, Erfahrung und das richtige Timing“, so der Mitgründer. „Das kann KI aus unserer Sicht nicht ersetzen.“

Fazit & Ausblick

Cleverklagen zeigt eindrücklich, dass gesundes Wachstum ohne Investorinnen auch im anwaltlichen Dienstleistungssektor funktionieren kann. Die eigentliche Herausforderung für das Duo dürfte künftig jedoch weniger in der hauseigenen Softwareentwicklung liegen, sondern in der profitablen und skalierbaren Kund*innenakquise.

Wo sieht sich das Unternehmen in zwei Jahren? Lucas Rößler hat klare finanzielle Ambitionen: „Wenn weiterhin alles gut läuft, haben wir unseren Umsatz und Gewinn in zwei Jahren idealerweise mehr als verdoppelt.“ Ob man die vertikale Marktführerschaft im Arbeitsrecht erzwingen könne, werde sich zeigen.

Interessant ist jedoch die strategische Ausrichtung für die Zukunft: Cleverklagen plant die Expansion in weitere Rechtsgebiete. Dabei wolle man sich explizit nicht auf standardisierte Massenverfahren fokussieren, verrät Rößler: „Wir wollen Rechtshilfe in Bereichen bieten, in denen Menschen echte und oft existenzielle Unterstützung benötigen. Zum Beispiel bei Streitigkeiten mit Versicherungen oder bei familien- oder erbrechtlichen Fragen.“

Boschs 200-Mio.-Euro-Wette: Kann der Industrieriese wirklich Start-up?

Bosch pumpt frische Millionen in seinen hauseigenen Venture Builder. Während andere Konzerne ihre Inkubatoren dichtmachen, will der Stuttgarter Hardware-Gigant externe Gründer*innen anlocken und tiefe Tech-Innovationen ausgründen. Ein vielversprechendes Modell für DeepTech-Start-ups – oder eine strategische Sackgasse?

Bosch Business Innovations, der Corporate Venture Builder der Bosch Gruppe, investiert in den kommenden fünf Jahren rund 200 Millionen Euro in den Aufbau neuer DeepTech-Ventures. Das ehrgeizige Ziel: Bis 2030 sollen 20 neue Start-ups außerhalb des Bosch-Kerngeschäfts aufgebaut und zur Marktreife geführt werden. Doch die Ankündigung fällt in eine Zeit, in der das Modell Corporate Venture Building (CVB) in Europa in einer tiefen Krise steckt. Konzern-Inkubatoren von SAP, Allianz oder ProSiebenSat.1 haben in der Vergangenheit längst die Segel gestrichen. Warum glaubt Bosch, die Ausnahme von der Regel zu sein?

DeepTech trifft auf Konzern-Ressourcen

Im Gegensatz zur reinen Investment-Tochter Bosch Ventures (Robert Bosch Venture Capital), die als klassischer Geldgeberin agiert, will Bosch Business Innovations Unternehmen von Grund auf selbst bauen. Zum Start konzentriert sich die Einheit auf drei hochkomplexe Bereiche: medizinische Fernüberwachung, softwaregesteuerte Fertigung und Carbon Capture.

Der Pitch an die Szene klingt verlockend: Bosch verschafft Gründungsteams einen kuratierten Zugang zu Patenten, Forschung, Testlaboren, Ingenieurwissen und globalen Lieferketten. Im Bereich Carbon Capture will man beispielsweise direkt auf bestehende Patente und technologische Vorarbeiten des Konzerns aufsetzen. Externe Gründerinnen und Gründer sollen dabei frühzeitig Verantwortung übernehmen und die Unternehmen von Anfang an aufbauen. Axel Deniz, Geschäftsführer von Bosch Business Innovations, formuliert es so: Man wolle die Technologie und die industrielle Stärke von Bosch mit der Geschwindigkeit und dem unternehmerischen Denken der Start-up-Welt verbinden.

Gegen den „CVB-Winter“

Dass Bosch genau jetzt diese Summen lockermacht, ist ein starkes Signal gegen den aktuellen „CVB-Winter“. Viele Konzern-Inkubatoren scheitern traditionell an der mangelnden Geduld des Mutterkonzerns, quälend langsamen Freigabeprozessen oder einer zu engen inhaltlichen Fesselung an das Bestandsgeschäft.

Bosch versucht, diese strukturellen Fehler zu umgehen, indem der Fokus explizit auf neuen Märkten jenseits des Kerngeschäfts liegt. Zudem öffnet sich die Einheit gezielt für die Außenwelt: Die Zusammenarbeit mit externen Venture Studios und Investor*innen soll den Zugang zu Ökosystemen verbessern und vor allem zusätzliches Kapital mobilisieren. Die Ventures sollen bis zur Investment Readiness begleitet werden und setzen dabei auf Co-Investments. Dass dieser Spin-off-Ansatz Früchte tragen kann, zeigte unlängst der erfolgreiche Exit des Corporate-Start-ups Bosch Advanced Ceramics, das aus dem Bosch-Inkubator hervorging und zum Jahreswechsel 2025/2026 an den japanischen Anlagenbauer Sintokogio verkauft wurde.

Wo liegt der Haken für Gründer*innen?

Trotz dieser Erfolge hat das Modell Tücken, die man kritisch prüfen muss. Die zentrale Frage für externe Gründer*innen lautet: Wie unabhängig kann ein Start-up wirklich agieren, wenn der entscheidende IP-Zugang (Patente, Technologie) vom Mutterkonzern kontrolliert wird?

- Geschwindigkeit vs. Konzernstruktur: Start-ups brauchen Agilität und Pivot-Bereitschaft. Konzerne hingegen neigen dazu, sich durch Vetorechte oder strategische Kontrollmechanismen abzusichern. Es besteht immer die Gefahr, dass der Corporate-Partner eher als Bremse denn als Beschleuniger wirkt.

- Die Cap-Table-Falle: Wenn Bosch das Initialkapital stellt, die Patente einbringt und die Infrastruktur liefert, bleibt für externe Gründungsteams oft nur ein Bruchteil der Anteile. Eine „schiefe“ Cap Table (Kapitalverteilung) kann jedoch spätere VC-Runden massiv erschweren, da externe Investor*innen motivierte Gründer*innen mit signifikanten Anteilen sehen wollen.

- IP-Rechte: Wem gehört die Technologie, wenn das Start-up scheitert oder sich vom Konzern lösen will? Ohne saubere und gründungsfreundliche IP-Transfer-Bedingungen wird jedes Venture zum Gefangenen seines Inkubators.

Unser Fazit: Ein Deal für Heavy-Tech, nicht für Software-Shootingstars

Für Gründer*innen im B2C- oder reinen Software-SaaS-Bereich ist das Angebot von Bosch Business Innovations uninteressant; hier genügen klassische VCs und die eigene Agilität. Wer jedoch im DeepTech-Sektor gründen will – sei es in der industriellen Dekarbonisierung oder der Medizintechnik –, steht oft vor einem enormen Hardware- und Kapital-Bottleneck. Die Entwicklungskosten sind hier astronomisch hoch.

In genau diesen „Hard Tech2-Feldern kann das Angebot von Bosch ein echter Katalysator sein. Der Zugang zu einer der weltweit größten Patentbibliotheken und industrieller Skalierung senkt das Technologierisiko enorm.

Das 200-Millionen-Euro-Commitment ist ein wichtiges Bekenntnis zum DeepTech-Standort Deutschland. Wer als Gründungsteam einsteigt, sollte sich jedoch nicht von den großen Ressourcen blenden lassen, sondern vorab knallhart über Anteile, operative Eigenständigkeit und IP-Rechte verhandeln. Nur wenn Bosch den Gründer*innen echte Beinfreiheit lässt, entstehen hier bis 2030 tatsächlich 20 flugfähige Start-ups – und nicht nur teure, konzerninterne Forschungsprojekte.

110-Mio.-Dollar-Turbo: Sereact verpasst Robotern eine Vorstellungskraft

Mit 110 Mio. Dollar frischem Kapital und „Cortex 2“ greift das Stuttgarter Start-up Sereact die USA an. Die Vision: Roboter, die physikalisch mitdenken, statt nur blind zuzugreifen.

Das 2021 gegründete Stuttgarter Start-up Sereact hat in einer aktuellen Serie-B-Finanzierungsrunde 110 Millionen US-Dollar eingesammelt. Mit dem Versprechen, Industrierobotern durch sogenannte „Weltmodelle“ eine Art situative Vorstellungskraft zu verleihen, zieht das Unternehmen erneut internationale Schwergewichte an. Doch während die Kriegskasse für die anstehende US-Expansion prall gefüllt ist, stellt sich die Frage: Kann der datengetriebene Ansatz aus dem Schwabenland die hochfinanzierte US-Konkurrenz auf ihrem Heimatmarkt wirklich ausstechen? Eine Analyse.

Millionen-Spritze für den Weltmarkt

Die Gründungsgeschichte von Sereact liest sich wie ein europäischer Tech-Traum. Ralf Gulde (CEO) und Marc Tuscher (CTO) starteten 2021 als Ausgründung der Universität Stuttgart. Was mit improvisierten Servern aus gebrauchten Grafikkarten begann, hat sich zu einem globalen Geschäft entwickelt: Nach einer Serie-A-Runde im Jahr 2025 führt nun der VC Headline die 110-Millionen-Dollar-Runde an. Beteiligt sind zudem Bullhound Capital, Daphni und Felix Capital, womit das Gesamtkapital auf über 140 Millionen US-Dollar steigt.

Der Grund für das massive Interesse liegt in der Skalierbarkeit: Mit über 200 europaweit eingesetzten Systemen gilt Sereact als einer der am häufigsten eingesetzten Anbieter von KI-Kommissionierrobotern. Die Kundenliste umfasst Größen wie BMW, Mercedes-Benz, DHL, PepsiCo und die Österreichische Post.

Cortex 2: Denken vor dem Greifen

Bisher basierte der Erfolg auf der Koppelung von Sprachmodellen und Bilderkennung. Mit der neuen Generation „Cortex 2“ geht Sereact einen Schritt weiter: Das System erweitert ein Vision-Language-Action-Modell (VLA) um ein „Weltmodell“. Anstatt nur zu reagieren, gleicht die KI Aktionen mit einem erlernten Modell der Physik ab und wählt den vielversprechendsten Weg aus.

Dieser Wechsel vom Reagieren zum Schlussfolgern ermöglicht komplexe Aufgaben, bei denen feinfühliger Kontakt entscheidend ist – etwa das Zusammenbauen von Komponenten unter Spannung oder das kratzerfreie Anbringen eines Scheibenwischers. CTO Marc Tuscher betont: „Wir bauen keine Roboter. [...] Die Hardware wird zur Massenware. Das Modell nicht.“

Der Eine-Milliarde-Picks-Vorsprung

Sereact positioniert sich als reines Software-Unternehmen, sieht seinen entscheidenden Vorteil jedoch in der Datenqualität. Ein kritischer Blick auf den Markt zeigt:

- Reale Daten vs. Simulation: Während viele Wettbewerber mit simulierten Daten trainieren, wurde Cortex 2 auf Basis von mehr als einer Milliarde realer Greifvorgänge aus der Produktion entwickelt.

- Nachgewiesene Präzision: Sereact begegnet der Skepsis gegenüber KI in der Logistik mit harten Zahlen. Laut Unternehmen erfordert nur noch jeder 53.000. Kommissioniervorgang ein menschliches Eingreifen.

- Hardware-Abhängigkeit: Trotz der Software-Stärke bleibt Sereact darauf angewiesen, dass Kunden in moderne Roboterarme und Sensorsysteme wie die hauseigene „Sereact Lens“ investieren.

Showdown in den USA

Mit der Präsentation auf der MODEX in Atlanta und der geplanten Eröffnung eines Büros in Boston in diesem Sommer bläst Sereact zum Angriff auf den US-Markt. Amerikanische Hersteller fordern produktreife KI, die sofort einsatzbereit ist.

Für die Gründer*innenszene sendet Sereact ein klares Signal: Der nächste Paradigmenwechsel der KI findet in der physischen Welt statt (Embodied AI). Der Erfolg in den USA wird davon abhängen, ob das Stuttgarter Daten-Flywheel auch gegen die gigantischen Budgets der US-Konkurrenz bestehen kann. Sereact hat den Grundstein gelegt, um das „Gehirn“ der globalen Automatisierung zu werden.

Gründer*in der Woche: Vjus.AI – Vom SEO zum GEO

Wie das 2026 von Wolfe Diener gegründete Start-up Vjus.AI den Kampf um die KI-Sichtbarkeit gewinnen will.

Die Ära der klassischen Suchmaschinenoptimierung (SEO) bekommt ernstzunehmende Konkurrenz. Wenn Nutzer*innen heute nach Produkten oder Dienstleistungen suchen, tippen sie ihre Fragen zunehmend in Dialogfenster von Sprachmodellen statt in traditionelle Suchschlitze. Genau an dieser Schnittstelle positioniert sich das neu gestartete Münchner Start-up Vjus.AI. Doch kann eine Software wirklich die „Black Box“ der generativen KI entschlüsseln – und wie nachhaltig ist das Geschäftsmodell?

Hinter der am 1. April 2026 offiziell gelaunchten Plattform steht die AtWize Business Services GmbH mit Sitz in München. Kopf des Unternehmens ist Gründer Wolfe W. Diener, der zuvor bereits in leitenden Positionen als Geschäftsführer und im Vorstand großer Softwarehäuser aktiv war. Mit dem Start von Vjus.AI vollzieht das Unternehmen nun eine strategische Erweiterung in den stark wachsenden Bereich der Answer Engine Optimization (AEO) und Generative Engine Optimization (GEO).

Vom Humankapital zur KI-Sichtbarkeit

Die Historie des Unternehmens ist dabei von einem interessanten Strategiewechsel geprägt. Ursprünglich startete AtWize 2023 mit einem Fokus auf KI-Lösungen gegen den Fachkräftemangel. Diener erklärt die Hintergründe: „Parallel hatte ich schon eine Weile an der Idee arbeitete, Unternehmen zu ermöglichen, ihre in den Ruhestand ausscheidenden Mitarbeiter strukturierter zu managen, um sie bei Bedarf für Projekte oder übergangsweise anzusprechen. Es liegt so viel Humankapital und Erfahrung brach.“ In der aktuellen wirtschaftlichen Phase sei dies jedoch kein Top-Thema gewesen, weshalb man sich zunächst auf die Software-Entwicklung für Dritte konzentriert habe.

Der eigentliche „Aha-Moment“ kam durch die tägliche Arbeit. „Im letzten Jahr haben wir dann immer mehr auch KI-Tools zur Entwicklung eingesetzt und dabei den Bedarf, sogar die Notwendigkeit erkannt, die Sichtbarkeit in KI-Modellen zu messen und zu verbessern“, so Diener. Die Dringlichkeit begründet er mit dem veränderten Nutzer*innenverhalten: „KI-Modelle geben begründete Empfehlungen zur gestellten Frage. Da sucht man nicht weiter, sondern nimmt das Ergebnis wie es ist. Wer da nicht enthalten ist, ist unsichtbar.“

Nutzer*innensimulation: Die reale Perspektive

Vjus.AI setzt auf die Simulation realer Suchanfragen. Während klassische SEO-Tools oft auf APIs zugreifen, misst diese Plattform, wie Marken in Antworten von ChatGPT, Gemini, Grok oder Perplexity tatsächlich erscheinen. Auf die Frage nach der technischen Umsetzung und der Nicht-Deterministik der KI-Modelle antwortet Diener detailliert: „Wenn Sie Ihre Sichtbarkeit bei KI-Suchen wissen wollen, dann sollte diese ja so gemessen werden, wie sie ein normaler Nutzer, der einem KI-Modell eine Frage stellt, einen Prompt eingibt, auch sieht.“ Man müsse also zunächst Prompts definieren, bei denen man gefunden werden wolle – etwa als Münchner Zahnarzt bei der Frage nach dem besten Zahnarzt vor Ort.