Aktuelle Events

Mit personalisierten Produkten starten – welches Shop-System ist dafür geeignet?

Derzeit befinden wir uns in einer Zeit, in welcher der Onlinehandel mehr floriert denn je. Wer bisher ausschließlich auf den Einzelhandel gesetzt hat, der hat es derzeit aufgrund des Lockdowns schwer. Sicherlich entsteht dadurch auch Tatendrang, denn gerade personalisierte Produkte können jetzt vielleicht einfacher verkauft werden. Doch alles startet zuerst einmal mit dem richtigen Shop-System.

Nicht jedes Shop-System ist für jedes Anliegen geeignet, insbesondere bei personalisierten Produkten stoßen verschiedene Systeme schnell an ihre Grenzen. Daher ist es wichtig, dass man sich einen Überblick verschafft. Wie sieht es mit den eigenen Anforderungen aus und wie mit der möglichen Usability. Die Usability ist essenziell, denn Kunden strafen komplizierte Systeme schnell ab.

Welche Shop-Systeme gibt es zur Auswahl?

Heutzutage gibt es eine große Auswahl an Shop-Systemen, welche nach den persönlichen Anforderungen betrachtet werden sollten. Hierzu zählen zum Beispiel diese Anbieter oder Softwaresysteme:

- WooCommerce

- Shopware

- Shopify

- Plentymarkets

- Jimdo Onlineshop

- JTL Shop

- CosmoShop

Jedes dieser Systeme hat zum Teil auch einen großen Bestand an bereits vorgefertigten Designs und Erweiterungen. Dadurch können Automatismen unkompliziert angelegt werden, andererseits können aber auch Marketing-Tools verwendet werden. Der Bau einer Landingpage ist zum Beispiel wichtig, damit Werbeanzeigen effektiver geschaltet werden können, genauso aber auch, um besser in den organischen Suchergebnissen gefunden zu werden.

Für personalisierte Produkte müsste entsprechend recherchiert werden. Für WooCommerce gibt es zum Beispiel das Plugin „Product Option Manager“ oder für Shopify die App „Inkybay Produkt-Customizer“. Bei Shopware kann auf den „Produktdesigner“ zurückgegriffen werden und bei JTL können Variationen hinzugefügt werden, wodurch ein Freitext ergänzt werden kann.

Verkauf auf weitere Plattformen

Produkte, wie z.B. personalisierte Baby Artikel werden immer beliebter und danach suchen Nutzer auch auf anderen Plattformen. Es ist daher wichtig, dass es eine Anbindung gibt zwischen dem eigenen Shop und den Marktplätzen wie eBay, Amazon oder auch Google Shopping.

Bei Shopify ist das bereits integriert und muss lediglich verknüpft werden, aber bei anderen Systemen wie WooCommerce wird dafür zuerst ein Plugin installiert. Je nach Umfang kann die Anbindung aber auch etwas kosten. Wenn das Plugin funktioniert und es dadurch zu mehr Umsatz kommt, kann dieser Betrag aber i. d. Regel aber gut verkraftet werden.

Der Vorteil dabei ist, dass der Nutzer auf einer gewohnten Umgebung (wie Amazon) einkauft. Im Paket kann eine Werbung hinzugelegt werden, sodass der Kunde beim nächsten Mal vielleicht nicht über den Marktplatz kauft, sondern direkt im eigenen Shop. Damit werden künftige Gebühren gespart und der Kunde so schnell zum Stammkunden.

Was kostet ein eigener Onlineshop?

Die Kosten für einen Onlineshop spielen insbesondere am Anfang eine essenzielle Rolle, denn die Finanzierung muss immerhin gewährleistet sein. Es kommt darauf an, welche Funktionen bereitstehen müssen und wie der Ablauf im Hintergrund organisiert wird. So besteht auch die Möglichkeit eines Dropshipping-Shops, wodurch kein eigener Warenbestand vorliegt.

Ein System wie WooCommerce kann für wenige Euro im Jahr (zuzüglich der Kosten für das Plugin zur Produktindividualisierung) betrieben werden, aber dafür muss auch viel selbst eingerichtet werden. Bei dieser Software gibt es aber auch sehr gute Möglichkeiten zur Individualisierung bezüglich des Webdesigns – daraus kann recht einfach eine Marke kreiert werden.

Bei fertigen Systemen für „mittelgroße Händler“ gibt es auch Systeme wie Jimdo, dessen Einrichtung sehr schnell geschieht – hier beginnen die Preise ab 228 Euro. Wenn bereits technische Kenntnisse vorliegen, kann sich definitiv auch an WooCommerce gewagt werden.

Diese Artikel könnten Sie auch interessieren:

Was macht das „perfekte Give-away“ auf einer Messe aus?

Erfahren Sie hier mehr dazu, wie das „perfekte Give-away“ für Messen und Co. aussieht.

Messen gehören weiterhin zu den wichtigsten Plattformen für Neukundengewinnung, Markenpräsentation und Geschäftsanbahnung. Trotz zunehmender Digitalisierung bleibt der persönliche Kontakt für viele Unternehmen ein entscheidender Erfolgsfaktor. Gerade deshalb spielt auch die Auswahl passender Give-aways eine wichtige Rolle. Werbegeschenke gehören seit Jahrzehnten zum festen Bestandteil von Messeauftritten und sollen Aufmerksamkeit erzeugen, Gespräche fördern und langfristig in Erinnerung bleiben.

Allerdings hat sich die Erwartungshaltung rund um klassische Werbeartikel deutlich verändert. Ein einfacher Kugelschreiber oder ein günstiger Streuartikel reicht heute oft nicht mehr aus, um nachhaltig wahrgenommen zu werden. Besucher achten stärker auf Nutzen, Qualität, Nachhaltigkeit und Design. Das perfekte Give-away erfüllt deshalb mehrere Funktionen gleichzeitig: Es schafft Wiedererkennung, transportiert Markenwerte und besitzt einen tatsächlichen Mehrwert im Alltag. Die folgenden Abschnitte liefern hierzu einige spannende Inspirationen.

Der praktische Nutzen entscheidet über den eigentlichen Wert

Einer der wichtigsten Faktoren für erfolgreiche Give-aways bleibt der praktische Nutzen. Werbeartikel, die regelmäßig verwendet werden, sorgen automatisch für eine höhere Sichtbarkeit der Marke. Genau deshalb gewinnen funktionale Produkte seit Jahren an Bedeutung.

Besonders beliebt sind langlebige Alltagsgegenstände wie Notizbücher, Ladegeräte oder Trinkflaschen. Vor allem hochwertige und nachhaltige Produkte erzeugen häufig einen deutlich besseren Eindruck als günstige Massenware. Unternehmen setzen deshalb zunehmend auf individuell gestaltete Werbeartikel mit langfristigem Nutzwert. Eine personalisierte Trinkflasche von Flaschenfreunde.de verbindet beispielsweise Funktionalität, Nachhaltigkeit und Markenpräsenz in einem Produkt. Gerade auf Messen können solche Artikel langfristig sichtbar bleiben, weil sie im Büro, unterwegs oder beim Sport regelmäßig genutzt werden.

Hinzu kommt der Nachhaltigkeitsaspekt. Wiederverwendbare Produkte wirken moderner und verantwortungsbewusster als kurzlebige Werbeartikel aus Plastik. Viele Unternehmen achten deshalb bewusst darauf, Give-aways auszuwählen, die Umweltbewusstsein und Markenimage gleichzeitig unterstützen.

Qualität statt Masse

Früher lag der Fokus vieler Messeauftritte auf möglichst großen Mengen günstiger Werbeartikel. Heute verändert sich diese Strategie zunehmend. Hochwertige Give-aways erzielen oft eine stärkere Wirkung als große Stückzahlen einfacher Streuartikel.

Besucher verbinden die Qualität eines Give-aways häufig direkt mit der Qualität eines Unternehmens. Ein schlecht verarbeitetes Produkt kann dadurch sogar einen negativen Eindruck hinterlassen. Hochwertige Materialien, ansprechendes Design und eine sinnvolle Verpackung gewinnen deshalb an Bedeutung.

Besonders im B2B-Bereich spielt Wertigkeit eine große Rolle. Geschäftspartner und potenzielle Kunden erwarten professionelle Präsentationen und durchdachte Markenauftritte. Ein hochwertiges Give-away signalisiert Aufmerksamkeit und schafft einen positiveren Gesamteindruck.

Dabei muss ein gutes Werbegeschenk nicht zwangsläufig teuer sein. Entscheidend bleibt vor allem die Kombination aus Nutzen, Gestaltung und Zielgruppenrelevanz.

Der Faktor Zielgruppenorientierung wird immer wichtiger

Das „perfekte Give-away“ funktioniert nicht für jede Branche oder Zielgruppe gleichermaßen. Unternehmen müssen deshalb genau analysieren, welche Produkte tatsächlich zu den Interessen ihrer Besucher passen.

Technologieunternehmen setzen häufig auf praktische Büroartikel oder digitale Gadgets, während nachhaltigkeitsorientierte Marken eher auf wiederverwendbare Produkte oder ökologische Materialien achten. Auch Alter, Berufsfeld und Nutzungskontext spielen eine wichtige Rolle.

Gerade auf Fachmessen gewinnt Personalisierung an Bedeutung. Besucher möchten keine beliebigen Werbeartikel mehr sammeln, sondern Produkte erhalten, die tatsächlich relevant wirken. Individuell ausgewählte Give-aways erhöhen deshalb die Wahrscheinlichkeit, dass ein Artikel langfristig genutzt wird.

Zusätzlich kann ein Give-away die Markenbotschaft direkt unterstützen. Unternehmen mit Fokus auf Innovation wählen häufig moderne Technologien, während traditionelle Marken stärker auf klassische und langlebige Produkte setzen.

Auch ein wichtiges Thema: Kundenbindung im Online-Handel durch Give-aways

Give-aways spielen längst nicht mehr nur auf Messen eine wichtige Rolle. Auch im Online-Handel gewinnen kleine Zusatzprodukte zunehmend an Bedeutung, wenn es um Kundenbindung und Markenwahrnehmung geht.

Viele Unternehmen legen Bestellungen kleine Geschenke, Rabattcodes oder personalisierte Artikel bei, um das Einkaufserlebnis emotional aufzuwerten. Gerade im E-Commerce fehlt häufig der persönliche Kontakt, den stationäre Geschäfte oder Messen automatisch erzeugen. Zusätzliche Give-aways können diese Distanz teilweise ausgleichen.

Besonders wirkungsvoll sind oft Produkte, die einen echten Mehrwert bieten und regelmäßig genutzt werden. Dadurch bleibt die Marke auch nach dem Kauf dauerhaft präsent. Gleichzeitig erhöhen hochwertige Zugaben oft die Wahrscheinlichkeit von Wiederbestellungen oder positiven Bewertungen.

Darüber hinaus fördern Give-aways im Online-Handel häufig die Sichtbarkeit in sozialen Netzwerken. Kreative oder hochwertige Produkte werden eher fotografiert, geteilt oder weiterempfohlen und erzeugen dadurch zusätzliche Reichweite.

Ein besonderer Trend: Smarte Gadgets in unterschiedlichen Preisklassen

Neben klassischen Werbeartikeln gewinnen smarte Gadgets zunehmend an Bedeutung. Besonders auf technologieorientierten Messen oder im B2B-Umfeld wirken moderne Produkte häufig innovativer und zeitgemäßer.

Dabei existieren, wie auf den Seiten von homeandsmart immer wieder zu sehen ist, inzwischen zahlreiche Lösungen in unterschiedlichen Preisklassen. Günstigere Varianten umfassen beispielsweise Webcam-Abdeckungen, Smartphone-Halter oder kleine USB-Accessoires. Im mittleren Segment sind Powerbanks, Bluetooth-Tracker oder kabellose Ladegeräte beliebt.

Hochwertigere Give-aways setzen häufig auf technische Innovation und Premium-Charakter. Dazu gehören beispielsweise smarte Trinkflaschen, kabellose Kopfhörer oder multifunktionale Reisegadgets.

Solche Produkte erzeugen meist eine stärkere emotionale Wirkung, werden jedoch gezielter an wichtige Geschäftspartner oder Bestandskunden vergeben.

Entscheidend bleibt auch hier die Zielgruppenrelevanz. Nicht jedes Gadget passt automatisch zu jeder Marke. Unternehmen sollten deshalb darauf achten, dass technische Give-aways tatsächlich sinnvoll wirken und nicht ausschließlich als kurzfristiger Effekt dienen.

Nachhaltigkeit wird zum entscheidenden Faktor

Nachhaltigkeit entwickelt sich zunehmend zu einem zentralen Auswahlkriterium bei Werbeartikeln. Viele Besucher achten heute bewusst darauf, ob Give-aways langlebig, wiederverwendbar oder ressourcenschonend produziert sind.

Kurzlebige Plastikprodukte verlieren deshalb an Bedeutung. Stattdessen setzen Unternehmen häufiger auf Materialien wie Edelstahl, Glas, Holz oder recycelte Stoffe. Auch regionale Produktion und faire Herstellungsbedingungen gewinnen an Relevanz.

Nachhaltige Give-aways stärken nicht nur das Markenimage, sondern erhöhen oft auch die tatsächliche Nutzungsdauer eines Produkts. Werbegeschenke mit Umweltbezug wirken dadurch häufig hochwertiger und glaubwürdiger.

Gerade jüngere Zielgruppen reagieren zunehmend sensibel auf unnötige Wegwerfartikel. Unternehmen, die bewusst nachhaltige Lösungen einsetzen, können sich deshalb klar positiver positionieren.

Emotionale Wirkung bleibt im Fokus

Das perfekte Give-away erfüllt letztlich weit mehr als eine rein praktische Funktion. Es soll Aufmerksamkeit erzeugen, positive Emotionen auslösen und die Marke langfristig im Gedächtnis verankern.

Besonders erfolgreich sind oft Werbeartikel, die Überraschung, Qualität und Alltagstauglichkeit miteinander verbinden. Besucher erinnern sich oft weniger an den eigentlichen Messestand als an Produkte, die später regelmäßig genutzt werden.

Dabei spielt auch die Übergabe eine Rolle. Persönlich überreichte Give-aways wirken häufig wertiger als anonym verteilte Streuartikel. Gespräche, Beratung und individuelle Ansprache verstärken zusätzlich die emotionale Bindung.

Gerade deshalb investieren viele Unternehmen heute stärker in kleinere, aber hochwertigere Give-away-Konzepte statt in große Mengen austauschbarer Produkte.

Fazit

Das perfekte Give-away auf einer Messe kombiniert Nutzen, Qualität, Zielgruppenrelevanz und Markenwirkung. Während einfache Streuartikel zunehmend an Bedeutung verlieren, gewinnen hochwertige und nachhaltige Produkte immer stärker an Aufmerksamkeit.

Besonders funktionale Alltagsgegenstände, smarte Gadgets und personalisierte Produkte bleiben langfristig sichtbar und stärken die Markenpräsenz deutlich effektiver als kurzfristige Werbeartikel ohne Mehrwert. Gleichzeitig spielen Nachhaltigkeit und emotionale Wirkung eine immer größere Rolle.

Unternehmen, die Give-aways strategisch auswählen und konsequent an Zielgruppe und Markenimage ausrichten, schaffen nicht nur mehr Aufmerksamkeit auf Messen, sondern stärken langfristig auch oft die Kundenbindung und die Wiedererkennung.

Durchatmen in der KI-Ära: HR-Tech-Start-up Regulate sammelt 1,4 Mio. Euro ein

Ein neues B2B-Tool will die mentale Fitness in Unternehmen messbar machen. Hinter dem 2024 von Peter van Woerkum und Paul Laechelin gegründeten Münchner Breathwork-Start-up Regulate stehen prominente Szene-Köpfe. Doch kann eine App das grundlegende Problem struktureller Überlastung lösen?

Die Arbeitswelt verdichtet sich zusehends. Inmitten geopolitischer und wirtschaftlicher Unsicherheiten wird künstliche Intelligenz (KI) in alle Lebensbereiche integriert, was das Arbeitstempo spürbar beschleunigt. In diesem Spannungsfeld positioniert sich das Münchner Start-up Regulate. Das Unternehmen hat nun eine Seed-Finanzierungsrunde in Höhe von 1,4 Millionen Euro abgeschlossen.

Angeführt wird die Runde vom Impact-Investor 4impact.vc. Zu den Business Angels zählen zudem bekannte Namen der deutschen Startup-Szene, darunter Hanno Renner (Co-Founder & CEO, Personio), Mike Wax (Co-Founder, Forto), Marlena Hien (Co-Founder, Bears with Benefits) und Felix Haas (10x Group, Bits & Pretzels, IDnow).

Die Köpfe und die Historie

Hinter Regulate stehen CEO Peter van Woerkum und Paul Laechelin, die das Unternehmen im Jahr 2024 gründeten.

- Peter van Woerkum: Der Gründer ist ein zertifizierter Breathwork- und Executive-Coach, der auf über zehn Jahre Erfahrung in der C-Level-Beratung zurückblickt.

- Paul Laechelin: Als ehemaliger Product Lead für die BMW App bringt er die notwendige technische Expertise mit, um das Produkt für den Enterprise-Einsatz zu skalieren.

- Wissenschaftliches Fundament: Die inhaltliche Entwicklung der App erfolgte in Partnerschaft mit Prof. Dr. Hottenrott von der Martin-Luther-Universität Halle-Wittenberg. Die angebotenen Methoden basieren zudem auf Forschungen der Harvard Medical School und Stanford Medicine.

Das Geschäftsmodell: Präzision statt Gießkanne

Regulate grenzt sich bewusst von herkömmlichen Wellness-Apps ab. Anstatt allgemeine Meditationsübungen bereitzustellen, die in firmeninternen Benefit-Portalen oft ungenutzt bleiben, zielt die Plattform darauf ab, im passenden Moment die richtige Intervention anzubieten.

- Contextual Intelligence: Die App verknüpft sich mit Wearables und den digitalen Arbeitssystemen der Nutzer.

- On-Demand-Tool: Durch das Auslesen physiologischer Signale und die Analyse der Arbeitsstruktur werden personalisierte Atemübungen (Dauer: 90 Sekunden bis 60 Minuten) vorgeschlagen. Dies kann ein Fokus-Protokoll vor einem wichtigen Meeting oder eine Übung zur Beruhigung nach einer intensiven Diskussion sein.

- HR-Dashboard: Arbeitgeber erhalten aggregierte Dashboards, die HR- und Führungsteams Einblicke in Nutzungsmuster und Team-Resilienz geben, ohne die Privatsphäre des Einzelnen zu kompromittieren.

Das Geschäftsmodell stößt auf Resonanz: Innerhalb von weniger als zwölf Monaten wurden über 50.000 Sessions in der App absolviert. Die Enterprise-Pipeline umfasst ein potenzielles Volumen von über 9 Millionen Euro Annual Recurring Revenue (ARR). Zu den Kunden gehören unter anderem die Raiffeisen Bank International, Personio und Vattenfall. Mit dem neuen Kapital will Regulate das Wachstum beschleunigen, die Produktfunktionen vertiefen, Live-Formate ausbauen und europaweit expandieren.

Der Markt: Wachstumsdruck trifft auf Regulatorik

Regulate agiert in einem enormen Markt. Der globale Bereich für Stressmanagement am Arbeitsplatz wurde im Jahr 2023 auf 10,6 Milliarden US-Dollar geschätzt und wächst jährlich um 7,7 Prozent.

- Laut dem „State of the Global Workplace“ Report 2026 von Gallup gibt weltweit nur jede(r) dritte Arbeitnehmer*in an, am Arbeitsplatz zu „florieren“.

- Diese mangelnde Mitarbeiter*innenbindung kostet die Weltwirtschaft schätzungsweise 10 Billionen US-Dollar an ungenutzter Produktivität pro Jahr.

- Die Weltgesundheitsorganisation (WHO) bezifferte in einer Analyse von 2024 die zusätzlichen Kosten durch arbeitsplatzbedingte Angstzustände und Depressionen auf jährlich 1 Billion US-Dollar durch Produktionsausfälle.

Während in den USA vor allem direkte Gesundheitskosten die Arbeitgeberprogramme antreiben, wird der europäische Markt maßgeblich durch rechtliche Verpflichtungen geprägt. Die EU-Richtlinie zur Nachhaltigkeitsberichterstattung (CSRD) – seit Januar 2024 in Kraft – und die EU-Richtlinie zur Vereinbarkeit von Beruf und Privatleben zwingen Unternehmen zu mehr Transparenz und Berichterstattung beim Wohlbefinden der Belegschaft.

Unsere Einordnung: Heilsbringer oder Symptombekämpfung?

Aus Gründer*innen- und Investor*innensicht ist die Positionierung von Regulate strategisch klug. Der B2C-Markt für Achtsamkeit ist hochkompetitiv. Durch den strikten Fokus auf den B2B-Enterprise-Bereich und die nahtlose Integration in den Arbeitsalltag schafft Regulate eine starke Differenzierung. Besonders clever ist die Nutzung der europäischen CSRD-Richtlinie als Vertriebshebel: Unternehmen müssen Wohlbefinden reporten, Regulate liefert das passende aggregierte Dashboard direkt mit.

Trotzdem muss sich das Modell kritischen Fragen stellen:

- Symptombehandlung vs. Ursachenbekämpfung: Eine App kann strukturelle Überlastung durch Personalmangel, fehlendes Management oder toxische Unternehmenskulturen nicht lösen. Es besteht die Gefahr des „Wellbeing-Washings“, bei dem Unternehmen die Verantwortung für Stressbewältigung auf das Individuum abwälzen. CEO Peter van Woerkum betont zwar, dass die Plattform „keine weitere Stressquelle“ hinzufügen soll, doch in stark verdichteten Arbeitsumgebungen kann selbst ein technischer Push-Reminder zur Atemübung als belastend wahrgenommen werden.

- Datenschutz und Vertrauen: Die Koppelung physiologischer Wearable-Daten an ein vom Arbeitgeber finanziertes Dashboard betritt eine sensible Linie. Auch wenn Regulate betont, die Daten streng zu aggregieren, ist die Auswertung von Stressparametern am Arbeitsplatz – gerade in DACH-Unternehmen mit starken Betriebsräten – ein Terrain, das maximales Vertrauen der Belegschaft erfordert.

Fazit

Regulate hat erkannt, dass Corporate Health in Zukunft messbar und direkt in den Arbeitsalltag integriert sein muss. Kann das Start-up beweisen, dass seine Dashboards den Unternehmen helfen, Arbeitsbedingungen datenbasiert und strukturell zu verbessern, steht dem europaweiten Rollout kaum etwas im Wege.

Gründer*in der Woche: malmachen - Bootstrapping statt Pitchdeck

Kein VC-Geld, aber echte Kund*innen: Wie ein Start-up aus Deggendorf mit Voice-KI den Mittelstand adressiert – und warum Bootstrapping eine ernstzunehmende Alternative zum polierten Pitchdeck sein kann.

Während viele KI-Start-ups ihre Ideen zunächst in Präsentationen für Investoren entwickeln, sind drei Gründer aus Deggendorf einen anderen Weg gegangen. Marco Jülke, Leonhard Pöppel und Anton Kirchner bauen seit 2022 mit der malmachen GbR eine Telefon-KI ohne externes Funding und direkt im Markt auf. Zu einem Zeitpunkt, als es hierzulande kaum praxistaugliche Lösungen gab, begannen sie, reale Anwendungsfälle umzusetzen. Ihr Ansatz war dabei von Anfang an klar formuliert: Nicht erzählen, sondern bauen. Anstatt früh Kapital einzusammeln, arbeiteten sie unmittelbar an konkreten Kund*innenprojekten und entwickelten daraus über drei Jahre eine skalierbare Technologie.

In einem extrem rechen- und technologieintensiven Umfeld war das fehlende Risikokapital dabei durchaus spürbar. „Gerade am Anfang war Telefon-KI technisch extrem aufwendig, weil es kaum fertige Infrastruktur gab, auf die man einfach hätte aufsetzen können“, räumt Mitgründer Marco Jülke ein. Die Folge war viel eigenes Testen, Verwerfen und Neubauen. Rückblickend sieht Jülke in dieser finanziell herausfordernden Zeit jedoch einen entscheidenden Wettbewerbsvorteil. „Weil wir kein großes Kapital im Rücken hatten, konnten wir nicht einfach monatelang im stillen Kämmerlein entwickeln“, so der Gründer. Das Team war gezwungen, die Entwicklung über laufende Projekte zu finanzieren. „Wir haben nicht gebaut, was theoretisch spannend klingt, sondern das, wofür Unternehmen wirklich bereit waren zu zahlen.“ Dieser Druck habe letztlich für ein sehr praxisnahes Produkt gesorgt.

Vom Projektgeschäft zur Plattform

Die Use-Cases des Start-ups umfassen heute konkrete Anwendungen wie automatisierte Inbound-Systeme im Kund*innenservice, KI-gestützte Lead-Qualifizierung sowie Recruiting-Prozesse, bei denen Bewerber*innen ein telefonisches Erstgespräch mit einer KI führen. Ein besonderer Fokus liegt auf Outbound-Prozessen: KI-Systeme kontaktieren neue Leads innerhalb von Sekunden, führen Gespräche und qualifizieren Termine. Die Kundschaft reicht dabei vom Einzelunternehmen bis hin zum Konzern.

Doch gerade bei der Outbound-Telefonie bewegt man sich in Deutschland juristisch auf dünnem Eis. Die rechtlichen Hürden im Hinblick auf den Datenschutz (DSGVO) und das Gesetz gegen den unlauteren Wettbewerb (UWG) sind enorm hoch – automatisierte Kaltakquise ohne vorherige, ausdrückliche Einwilligung ist in der Regel unzulässig. Angesprochen auf die Gefahr, dass die KI für illegale Spam-Anrufe missbraucht werden könnte, zieht Leonhard Pöppel eine klare Haftungsgrenze. „Wir wollen ausdrücklich keine Technologie bauen, die für Spam oder aggressive Kaltakquise genutzt wird“, stellt er klar. Man setze plattformseitig auf strikte Nutzungsbedingungen. Die rechtliche Verantwortung für Datenherkunft und saubere Opt-ins bleibt jedoch beim Nutzer: „Unsere Kunden müssen selbst sicherstellen, dass sie eine rechtliche Grundlage für die Kontaktaufnahme haben.“ Pöppel sieht das Start-up dennoch in der Pflicht: „Unsere Verantwortung liegt darin, Missbrauch nicht zu fördern und Kunden für eine rechtssichere Nutzung zu sensibilisieren.“

Zuletzt vollzog das Unternehmen einen strategischen Wandel: Heute bündeln die Gründer ihre Technologie in einer Self-Service-Plattform und öffnen das Modell über White-Label-Lösungen für Agenturen. Dieser Wechsel senkt zwar die Einstiegshürde, erfordert nun aber ein hohes Nutzer*innen-Volumen, um profitabel zu wachsen.

„Die größte Hürde war, unser gesamtes Praxiswissen aus individuellen Kundenprojekten so zu vereinfachen, dass Unternehmen es selbst nutzen können“, resümiert Anton Kirchner den Pivot. Während man in der Dienstleistung vieles persönlich erklären könne, müsse das Produkt auf einer Plattform selbsterklärend sein. Um das notwendige Wachstum zu generieren, setzt das Team auf strategische Partnerschaften. „Gerade Agenturen sind für uns spannend, weil sie bereits Kundenbeziehungen haben und unsere Plattform nutzen können, um KI-Telefonie in bestehende Prozesse zu integrieren“, rechnet Kirchner vor.

Die Strategie der Marktmitte

Der Markt für KI-Telefonassistenten ist in den letzten 24 Monaten explodiert. Auf der einen Seite stehen hochfinanzierte Enterprise-Schwergewichte wie das Berliner Start-up Parloa, auf der anderen drängen globale US-Provider wie Vapi oder ElevenLabs in den DACH-Raum. Malmachen positioniert sich dazwischen: prozessnäher als reine US-Schnittstellen, aber zugänglicher als hochpreisige Enterprise-Lösungen.

Doch was hindert einen der globalen Tech-Riesen daran, den deutschen Mittelstand mit einem eigenen Frontend aufzurollen? Leonhard Pöppel verweist hierbei auf die Firmen-DNA: „Unser Ansatz war von Anfang an ein anderer – nicht aus Angst vor Wettbewerb zu handeln, sondern konsequent zu bauen, zu testen und zu verbessern. Genau daraus ist auch unser Name entstanden.“ Das über Jahre gewachsene operative Know-how im Mittelstand betrachten die Gründer als ihren eigentlichen Burggraben. „Ein globaler Player kann Technologie replizieren – aber nicht ohne Weiteres die gewachsene Marktkenntnis, die Nähe zu den Kunden und die daraus resultierende Produktqualität“, zeigt sich Pöppel überzeugt.

Profitabilität statt Pitchdeck

Für die Start-up-Szene liefert das Deggendorfer Unternehmen damit einen markanten Gegenentwurf zum üblichen Funding-first-Narrativ. Das Team beweist, dass es im kapitalintensiven KI-Sektor möglich ist, ohne Millionen-Runde und sofortigen Hyperscaling-Druck einen Product-Market-Fit anhand echter Umsätze zu validieren.

Ob das Team diesem Weg dauerhaft treu bleibt, ist offen. „Bootstrapping war für uns in der Anfangsphase genau der richtige Weg“, bilanziert Anton Kirchner. Beim Thema externes Kapital zeige man sich für das weitere Wachstum jedoch nicht dogmatisch. Sollte VC-Geld helfen, die Plattform professioneller zu skalieren, sei dies eine Option. Eine Bedingung knüpft Kirchner aber daran: „Es geht nicht um Geld allein. Der richtige Kapitalgeber sollte auch strategisch zu uns passen, Know-how mitbringen und Türen öffnen.“ Kapital nur um des Kapitals willen schließt der Gründer kategorisch aus.

Gründer*in der Woche: Brotrausch – Premium-Teig im recycelten Messbecher

Backen ohne Frust: Wie Brotrausch mit smarten Premium-Mischungen im recycelbaren Messbecher den hart umkämpften DIY-Brotmarkt aufmischen will.

Hinter der 2022 ins Leben gerufenen Marke Brotrausch, die 2023 offiziell an den Start ging, steht heute die Bremer Brot GmbH. Das Unternehmen hat die Marke im Jahr 2025 durch einen Asset Deal übernommen. An der Spitze des Start-ups steht ein Gründer, dessen Wurzeln weit abseits des klassischen Bäckerhandwerks liegen. Philipp Herrnberger, einst in der Sportvermarktung bei Werder Bremen tätig, gründete nicht aus einer entspannten Laune heraus, sondern aus gesundheitlichen Gründen. Nach dem Konsum von herkömmlichem Industrie-Brot kämpfte er immer wieder mit Beschwerden. Sein Antrieb: Ein bekömmliches, transparentes Brot ohne Zusatzstoffe zu kreieren, das man ohne Vorwissen einfach selbst backen kann.

Der Sprung aus der Agenturwelt in die Food-Szene war unkonventionell, doch genau das habe dem Team geholfen, „Dinge anders zu denken“, erinnert sich Herrnberger. In der ersten Phase finanzierte sich das anfänglich fünfköpfige Gesellschafterteam komplett aus eigenen Mitteln. Der Mix aus Bäckermeister, Kaufmann und Kreativen brachte dabei entscheidende Vorteile: „Wir konnten uns voll auf Produkt und Marke konzentrieren, ohne von Anfang an von externen Erwartungen getrieben zu sein“, erklärt der Geschäftsführer. Dennoch räumt er rückblickend offen ein, dass der Bootstrapping-Ansatz an seine Grenzen stieß. „Unter dem Strich muss man sagen, dass wir es ohne externe Investoren nicht geschafft haben“, resümiert Herrnberger über den rettenden Asset-Deal und Neustart im Sommer 2025.

Premium-Teig im recycelten Messbecher

Das Geschäftsmodell hebt sich bewusst vom preissensiblen Massenmarkt ab und richtet sich an all jene, denen im Post-Corona-Alltag schlichtweg die Zeit für aufwändige Sauerteig-Experimente fehlt. Hier setzt das Start-up mit absoluter Convenience an: Die neun natürlichen Brotmischungen erfordern laut Hersteller keinerlei Backerfahrung, kommen gänzlich ohne Küchenmaschine aus und beschränken sich auf rund zehn Minuten aktive Arbeitszeit. Die Zutaten für die „Made in Germany“-Strategie stammen aus kontrolliertem, regionalem Anbau.

Raffiniert und praktisch zugleich ist die Verpackungslösung: Die Mischungen ruhen in einem PET-Becher, der direkt als exakter Messbecher für die benötigte Wasserzugabe dient. Doch gerade ein Plastikbecher weckt in der nachhaltigkeitsgetriebenen Zielgruppe oft Skepsis. Herrnberger verteidigt die Entscheidung leidenschaftlich und verweist auf das rigorose Ausschlussverfahren in der Produktentwicklung. „Kraftpapiertüten sehen offensichtlich nachhaltig aus, wenn sie aber wie für uns beschichtet wären, können sie nur noch verbrannt werden“, kontert der Gründer. Dies sei überhaupt nicht im Sinne der Ressourcenschonung. Stattdessen setzt Brotrausch auf einen vollständig aus recyceltem PET bestehenden Becher einer deutschen Firma. Da die Pappbanderole raffiniert „einschnappt“ und nicht geklebt wird, seien beide Komponenten zu 100 Prozent wiederrecycelbar. Damit sei die Marke auch fit für zukünftige rechtliche Verpackungsvorschriften.

Smarte Nischen und margenstarkes Upselling

Anstatt den oft verlustreichen Preiskampf im regulären Supermarktregal zu suchen, etabliert sich Brotrausch konsequent als D2C-Marke im Premium-Segment. Eine reguläre Brotbackmischung schlägt mit 5,99 Euro zu Buche – eine echte Ansage für ein Produkt, in das die Kundschaft noch Strom, Wasser und Arbeitszeit investieren muss.

„Auf den ersten Blick wirkt der Preis natürlich hoch, vor allem, wenn man ihn rein mit Mehl vergleicht“, gibt Herrnberger zu bedenken. Dieser Vergleich greife jedoch zu kurz. „Wir verkaufen kein Rohprodukt, sondern ein durchdachtes Gesamterlebnis“, betont er und verweist auf die raffinierten Rezepturen und Prozesse, die zu einem Resultat führen, „das viele so zuhause sonst nicht hinbekommen würden“. Die Preisakzeptanz misst das Unternehmen primär über das Feedback und das Kaufverhalten. Als Kund*innen begannen, nicht nur ein zweites Mal zu bestellen, sondern direkt größere Pakete und mehrere Sorten in den Warenkorb legten, wusste das Team: Der Markt akzeptiert den Premium-Aufschlag. Zudem stellt Herrnberger klar: „Im Übrigen kostet das Backen im heimischen und relativ neuen Backofen keine 25 Cent.“

Aus den regulären Supermärkten hat sich Brotrausch mittlerweile bewusst zurückgezogen, da der Kampf um die Regale dort stark über den Preis diktiert wird. „Wir fokussieren uns nun auf Genusspartner wie Weinhändler, Hofläden oder Feinkosthändler, bei denen die Preise hochwertiger Produkte eher akzeptiert werden“, erklärt der Geschäftsführer den strategischen Kurswechsel.

Um die ambitionierte Preisgestaltung zu rechtfertigen, inszeniert das Start-up seine Produkte gezielt als Lifestyle-Upgrade – etwa für das autarke Vanlife beim Camping, als Mitbringsel zum Grillen oder für den Osterbrunch. Flankiert wird das Kernsortiment durch ein lukratives Upselling-Portfolio, das von stilvollen Geschenkboxen für knapp 30 Euro bis hin zu speziellen Baguette-Backblechen, Fruchtaufstrichen und Stullensalzen reicht. Diese Zusatzartikel seien laut Herrnberger zwar nicht essenziell für das Überleben des Unternehmens, da das Brotbacken der Mittelpunkt bleibe, sie seien aber entscheidend für das Wachstum. „Im E-Commerce geht es um den durchschnittlichen Warenkorb und die Retention“, analysiert der Gründer. Das Zusatzsortiment mache das „Erlebnis Brot“ noch intensiver. Der Umsatzanteil dieser lukrativen Extras liegt aktuell bei knapp 15 Prozent.

Die Gretchenfrage der Kund*innenbindung

Dieser strategische Ansatz sichert gesunde Margen und entzieht die Marke geschickt der Vergleichbarkeit mit Discountern. Dennoch bleibt eine große Herausforderung: Der Markt für DIY-Lebensmittel ist durch starke Bio-Traditionsmarken massiv umkämpft. Die größte Hürde besteht darin, die Wiederkaufsrate auf einem profitablen Niveau zu halten. Denn wenn die stylische Mischung primär als originelles Präsent zum Vatertag verschenkt wird, fehlen dem Unternehmen am Ende die wiederkehrenden Alltagsumsätze.

Einen aggressiven Rollout in den stationären Einzelhandel schließt Herrnberger vorerst aus. Dies sei nur mit hohen Investitionen machbar und berge das Risiko, zu einem „One-Hit-Wonder“ zu verkommen. Die Devise lautet stattdessen: „Wir wollen gesund wachsen, um profitabel zu werden.“ Die Geschenkboxen spielen in dieser Strategie eine überraschende Doppelrolle. Sie treffen nicht nur den Zeitgeist, sondern fungieren als cleverer Akquise-Kanal. „Wir erreichen dadurch Menschen, die uns vielleicht noch nicht kennen und unmittelbar mit der Marke, der Qualität und dem Erlebnis in Berührung kommen“, freut sich Herrnberger. Auf diese Weise spare man sich enorme Kund*innenakquisitionskosten. Zudem entwickle sich das Geschenke-Segment zunehmend zu einem echten Profitcenter im B2B-Bereich – etwa wenn Immobilienmakler die Boxen zur Hausübergabe als modernes „Brot und Salz“-Präsent nutzen.

Trotz der starken Nischen-Performance ist klar: Brotrausch muss langfristig beweisen, dass das Premium-Brot aus dem Becher nicht nur an Feiertagen verschenkt wird, sondern den dauerhaften Sprung in die alltägliche Frühstücksroutine der Konsument*innen schafft.

Württemberger Medien: Nachhaltige Wachstumsstrategien

Wie die Württemberger Medien Marketing Agentur Unternehmen mit datengetriebenen Strategien und klarer Positionierung unterstützt.

Digitale Sichtbarkeit ist heute für Unternehmen kein optionaler Erfolgsfaktor mehr, sondern eine Grundvoraussetzung. Märkte werden transparenter, Wettbewerber sichtbarer und Kunden anspruchsvoller. Wer sich behaupten will, muss nicht nur präsent sein, sondern gezielt kommunizieren, analysieren und optimieren. Genau an dieser Schnittstelle zwischen Strategie, Technologie und Kommunikation setzt die wtv Online Marketing Agentur an.

Das Unternehmen hat sich darauf spezialisiert, digitale Potenziale strukturiert zu erschließen und für seine Kunden messbar zu machen. Dabei geht es nicht um kurzfristige Maßnahmen oder einzelne Kampagnen, sondern um nachhaltige Strategien, die Wachstum langfristig unterstützen.

Von der Idee zur klaren digitalen Strategie

Viele Unternehmen starten mit einzelnen Marketingmaßnahmen, ohne eine übergeordnete Strategie zu verfolgen. Social-Media-Kanäle werden aufgebaut, Anzeigen geschaltet oder Inhalte produziert – oft ohne klare Zielsetzung oder langfristige Planung. Das Ergebnis: hohe Aufwände bei begrenzter Wirkung.

Die Württemberger Medien Agentur verfolgt bewusst einen anderen Ansatz. Im Mittelpunkt steht zunächst die Analyse. Bevor Maßnahmen umgesetzt werden, geht es darum, das Unternehmen, die Zielgruppe und den Markt genau zu verstehen.

Dazu gehören unter anderem:

- die Definition klarer Ziele und Zielgruppen

- die Analyse bestehender Marketingaktivitäten

- die Bewertung von Wettbewerbern und Marktposition

- die Identifikation von Potenzialen und Schwachstellen

Auf dieser Grundlage entsteht eine individuelle Strategie, die nicht nur kurzfristige Erfolge ermöglicht, sondern langfristig trägt.

Datenbasierte Entscheidungen statt Bauchgefühl

Ein wesentlicher Unterschied moderner Online-Marketing-Ansätze liegt in der Nutzung von Daten. Während Marketing früher oft stark von Erfahrung und Intuition geprägt war, stehen heute umfangreiche Analysemöglichkeiten zur Verfügung.

Die Württemberger Medien Agentur nutzt diese Möglichkeiten gezielt, um fundierte Entscheidungen zu treffen. Daten werden nicht nur gesammelt, sondern interpretiert und in konkrete Maßnahmen übersetzt. Dadurch lassen sich Maßnahmen kontinuierlich optimieren und Budgets effizient einsetzen.

Diese Arbeitsweise bringt mehrere Vorteile mit sich:

- bessere Planbarkeit von Marketingmaßnahmen

- transparente Erfolgsmessung

- gezielte Optimierung einzelner Kanäle

- langfristige Skalierbarkeit von Strategien

Gerade für wachsende Unternehmen ist diese Transparenz ein entscheidender Faktor.

Ganzheitlicher Blick auf digitale Kanäle

Online-Marketing besteht heute aus einer Vielzahl unterschiedlicher Disziplinen. Suchmaschinenoptimierung, Performance Marketing, Content-Strategie und Social Media greifen ineinander und beeinflussen sich gegenseitig.

Die Württemberger Medien Agentur betrachtet diese Bereiche nicht isoliert, sondern als Teil eines Gesamtsystems. Ziel ist es, die einzelnen Kanäle sinnvoll miteinander zu verknüpfen und so eine konsistente Markenkommunikation zu schaffen.

Dabei werden unter anderem folgende Bereiche integriert:

- Suchmaschinenoptimierung (SEO) für nachhaltige Sichtbarkeit

- Webdesign und Website-Entwicklung für einen professionellen digitalen Auftritt

- Digitale Mitarbeitergewinnung über zielgerichtete Online-Kampagnen

- Ganzheitliche strategische Beratung zur digitalen Sichtbarkeit und Kundengewinnung

Durch diese Verzahnung entsteht ein Marketingansatz, der sowohl kurzfristige Ergebnisse als auch langfristige Wirkung ermöglicht.

Fokus auf messbare Ergebnisse

Ein zentraler Anspruch der Württemberger Medien ist die Messbarkeit von Erfolg. Marketing wird nicht als kreativer Selbstzweck verstanden, sondern als strategisches Instrument zur Erreichung konkreter Unternehmensziele.

Das bedeutet, dass jede Maßnahme klar definierten Kennzahlen zugeordnet wird. Ob Traffic, Conversion-Rate oder Umsatz – die Ergebnisse werden kontinuierlich überprüft und ausgewertet.

Diese Transparenz schafft Vertrauen und ermöglicht es Kunden, ihre Investitionen nachvollziehbar zu steuern. Gleichzeitig bildet sie die Grundlage für eine kontinuierliche Weiterentwicklung der Strategie.

Zusammenarbeit auf Augenhöhe

Neben fachlicher Expertise spielt auch die Zusammenarbeit eine entscheidende Rolle. Die Württemberger Medien Agentur versteht sich nicht als externer Dienstleister im klassischen Sinne, sondern als strategischer Partner.

Das zeigt sich vor allem in der Kommunikation. Projekte werden eng mit den Kunden abgestimmt, Entscheidungen transparent getroffen und Entwicklungen regelmäßig besprochen. Ziel ist es, gemeinsam Lösungen zu entwickeln, die zum jeweiligen Unternehmen passen.

Diese partnerschaftliche Herangehensweise bringt mehrere Vorteile:

- klare Abstimmung von Zielen und Erwartungen

- schnelle Anpassung an Veränderungen

- langfristige Zusammenarbeit statt kurzfristiger Projekte

- bessere Integration in bestehende Unternehmensstrukturen

Gerade in dynamischen Märkten ist diese Flexibilität ein wichtiger Erfolgsfaktor.

Anpassungsfähigkeit in einem dynamischen Umfeld

Die digitale Welt verändert sich kontinuierlich. Neue Plattformen entstehen, Algorithmen werden angepasst und Nutzerverhalten entwickelt sich weiter. Für Unternehmen bedeutet das, dass Strategien regelmäßig überprüft und angepasst werden müssen.

Die Württemberger Medien Agentur begegnet dieser Dynamik mit einem flexiblen Ansatz. Statt starrer Konzepte setzt sie auf kontinuierliche Optimierung und Anpassung. Entwicklungen werden frühzeitig erkannt und in die Strategie integriert.

Dadurch bleiben Kunden nicht nur wettbewerbsfähig, sondern können neue Chancen aktiv nutzen.

Branchenübergreifende Erfahrung

Ein weiterer Vorteil der Württemberger Medien Online Marketing Agentur liegt in ihrer branchenübergreifenden Erfahrung. Zu den Kunden des Unternehmens zählen lokale und regionale Dienstleister, Handwerks- und Gewerbebetriebe sowie Unternehmen aus dem Mittelstand. Dadurch entsteht ein breites Verständnis für verschiedene Geschäftsmodelle, Zielgruppen und Marktmechaniken.

Diese Vielfalt hilft dabei, funktionierende Strategien nicht isoliert zu betrachten, sondern sinnvoll auf andere Bereiche zu übertragen. Was bei einem Dienstleistungsunternehmen zu mehr Sichtbarkeit und Anfragen führt, kann, richtig angepasst, auch für Handwerks- und Gewerbebetriebe sehr gut funktionieren. Gleichzeitig entstehen durch diese Perspektivwechsel oft innovative Ansätze, die über klassische Lösungen hinausgehen.

Dennoch bleibt jede Strategie individuell. Die Württemberger Medien Agentur setzt nicht auf standardisierte Konzepte, sondern passt Maßnahmen präzise an die jeweiligen Anforderungen an. Marktumfeld, Wettbewerbssituation und Zielgruppe werden dabei ebenso berücksichtigt wie interne Strukturen und Ressourcen des Kunden.

So entsteht ein ausgewogenes Verhältnis zwischen Erfahrung und Individualität – eine Kombination, die es ermöglicht, sowohl effizient als auch kreativ zu arbeiten und nachhaltige Ergebnisse zu erzielen.

Nachhaltiges Wachstum statt kurzfristiger Erfolge

Im Zentrum der Arbeit steht ein klares Ziel: nachhaltiges Wachstum. Während viele Marketingmaßnahmen auf schnelle Ergebnisse ausgerichtet sind, verfolgt die Württemberger Medien Agentur einen langfristigen Ansatz. Es geht nicht darum, kurzfristig Aufmerksamkeit zu erzeugen, sondern darum, stabile Strukturen aufzubauen, die dauerhaft funktionieren.

Das bedeutet, dass nicht nur einzelne Kampagnen optimiert werden, sondern das gesamte digitale Fundament eines Unternehmens gestärkt wird. Sichtbarkeit in Suchmaschinen, eine klare Markenpositionierung und eine gezielte Kundenansprache werden Schritt für Schritt aufgebaut und kontinuierlich weiterentwickelt.

Dabei spielen mehrere Faktoren zusammen. Eine technisch optimierte Website sorgt für eine bessere Auffindbarkeit, ein professioneller Markenauftritt stärkt die Außenwirkung und datenbasierte Kampagnen bringen gezielt Reichweite. Durch diese Kombination entsteht ein System, das nicht von einzelnen Maßnahmen abhängig ist, sondern als Ganzes wirkt.

Ein weiterer Vorteil dieses Ansatzes liegt in der Planbarkeit. Unternehmen erhalten eine klare Perspektive, wie sich ihre Marketingaktivitäten entwickeln und welche Ergebnisse realistisch zu erwarten sind. Gleichzeitig bleibt genügend Flexibilität, um auf Veränderungen im Markt zu reagieren und neue Chancen zu nutzen.

Dieser Fokus auf langfristige Entwicklung sorgt dafür, dass Unternehmen nicht nur kurzfristig wachsen, sondern sich nachhaltig im Wettbewerb positionieren können.

Fazit

Die Anforderungen an modernes Online-Marketing sind heute komplexer denn je. Unternehmen müssen sich in einem dynamischen Umfeld behaupten, ihre Zielgruppen verstehen und gleichzeitig effizient arbeiten. Gleichzeitig steigt der Druck, Marketingmaßnahmen nicht nur umzusetzen, sondern auch deren Wirkung nachvollziehbar zu machen.

Die Württemberger Medien Marketing Agentur zeigt, wie sich diese Herausforderungen strukturiert und zielgerichtet angehen lassen. Durch die Kombination aus datenbasierter Analyse, strategischer Planung und kontinuierlicher Optimierung entstehen Lösungen, die messbare Ergebnisse liefern und gleichzeitig langfristig tragen.

Besonders hervorzuheben ist der ganzheitliche Ansatz. Statt isolierter Maßnahmen entwickelt die Agentur ein umfassendes System, in dem alle digitalen Kanäle sinnvoll miteinander verknüpft sind. Dadurch wird nicht nur kurzfristige Sichtbarkeit erzeugt, sondern eine stabile Grundlage für nachhaltiges Wachstum geschaffen.

Für Unternehmen, die ihre digitale Präsenz gezielt ausbauen und langfristig stärken möchten, bietet dieser Ansatz eine klare Orientierung. Er verbindet Strategie, Technologie und Kommunikation zu einem durchdachten Gesamtbild – und schafft damit die Voraussetzungen für kontinuierlichen Erfolg in einem sich ständig verändernden Marktumfeld.

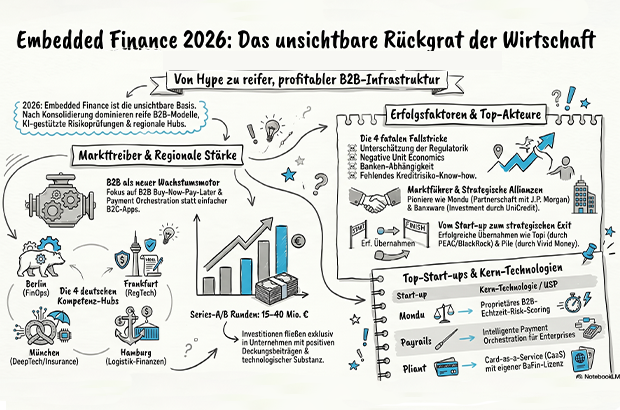

Embedded-Finance-Start-up-Report 2026

Der unsichtbare Bankensektor: Wie Embedded Finance und die dazugehörigen Start-ups die Wirtschaft des Jahres 2026 prägen.

Einst war es das große Versprechen für eine Handvoll hipper Neobanken, heute ist es das unsichtbare Rückgrat der europäischen Wirtschaft: Embedded Finance. Im Jahr 2026 wird das Marktwachstum längst nicht mehr von der fixen Idee isolierter Bank-Apps dominiert, denn jedes zukunftsorientierte Unternehmen ist mittlerweile selbst zu einem/einer Finanzdienstleister*in geworden. Ob Software-as-a-Service-Anbieter*in, Logistik-Plattform oder Marktplatz – die nahtlose Integration von Zahlungen, Krediten und Versicherungen in nicht-finanzielle Kund*innenreisen ist das neue Paradigma.

Dieser Report beleuchtet eine Branche, die den „Sturm der Konsolidierung“ überlebt hat und nun mit reifen Geschäftsmodellen und echten Profiten die Architektur der modernen Wirtschaft neu programmiert.

Vom Hype zur fundamentalen Reife

Nach den massiven Zinsanpassungen und regulatorischen Aufräumarbeiten der Jahre 2023 und 2024 zeichnet der Embedded-Finance-Markt heute ein Bild robuster Reife. Renommierte Analystenhäuser wie Bain & Company und Dealroom haben diese Entwicklung früh vorgezeichnet: Der globale Markt für Embedded-Finance-Dienstleistungen hat sich in ein Multimilliarden-Segment verwandelt, dessen europäisches Transaktionsvolumen mittlerweile signifikante Teile des digitalen B2B- und B2C-Handels stützt. Der technologische Haupttreiber dieser neuen Ära ist unbestreitbar die künstliche Intelligenz, genauer gesagt proprietäre Machine-Learning-Modelle, die Risikobewertungen in Millisekunden durchführen und Transaktionsströme dynamisch optimieren. Investor*innen honorieren diese technologische Tiefe: Wir sehen heute höchst realistische Series-A- und Series-B-Runden im Bereich von 15 bis 40 Millionen Euro für Start-ups, die nachweislich positive Deckungsbeiträge aufweisen. Es fließt wieder signifikant Kapital, doch es fließt exklusiv in Substanz und Skalierbarkeit, nicht mehr in reines Marketing.

Die neuen Treiber: B2B, Vertikalisierung und Orchestrierung

Wenn man über das Offensichtliche wie einfache White-Label-Kreditkarten hinausblickt, dominieren im Jahr 2026 drei spezifische Sub-Sektoren den Markt. Allen voran steht B2B Buy-Now-Pay-Later, eine Disziplin, die das traditionelle, schwerfällige Factoring abgelöst hat und nun direkt in B2B-Checkouts und Beschaffungsnetzwerke integriert ist. Ein weiterer massiver Treiber ist die sogenannte Payment Orchestration für vertikale SaaS-Lösungen. Hier werden komplexe, branchenspezifische Zahlungsflüsse – etwa im Handwerk oder in der Gastronomie – automatisiert im Hintergrund abgewickelt. Zuletzt etabliert sich Embedded Insurance zunehmend im Industriekontext, wo Maschinen nicht mehr nur geleast, sondern im selben Atemzug transaktionsbasiert versichert werden. Pioniere wie die Berliner Mondu oder auch europäische Schwergewichte wie Swan haben den Weg für diese hochspezialisierten Infrastruktur-Layer geebnet und gezeigt, wie tiefgreifend diese Geschäftsmodelle in die Wertschöpfungsketten der Realwirtschaft eingreifen.

Die Lektionen der BaaS-Krise

Doch dieser Reifegrad wurde teuer erkauft. Der Beinahe-Kollaps des britischen Banking-as-a-Service-Pioniers Railsr und die drastischen BaFin-Sonderprüfungen samt Wachstumsbeschränkungen bei etablierten deutschen Playern wie Solaris in den Jahren zuvor haben den Markt fundamental erschüttert. Der Traum, Finanzdienstleistungen wie einfache Legosteine zusammenzustecken, kollidierte brutal mit der harten Realität des Bankwesens.

Aus diesen gescheiterten Hoffnungen lassen sich für heutige Gründer*innen vier konkrete, fatale Fallstricke ableiten. Der erste und wichtigste ist die eklatante Unterschätzung der Regulatorik; Compliance lässt sich nicht auslagern, und Aufsichtsbehörden dulden keine agilen Versuch-und-Irrtum-Prozesse bei der Geldwäscheprävention. Der zweite Fallstrick ist die Falle der negativen Unit Economics im B2C-Sektor, wo exorbitante Kund*innenakquisitionskosten oft nur durch kontinuierliches VC-Geld gedeckt wurden. Drittens das Klumpenrisiko der Abhängigkeit von einer einzigen Partnerbank, deren Ausfall das eigene Start-up über Nacht handlungsunfähig macht. Und viertens die Fehlannahme, dass Technologie allein ausreicht; wer heute kein tiefes Verständnis für klassisches Bilanzstruktur- und Kreditrisikomanagement mitbringt, scheitert unweigerlich.

Das deutsche Netzwerk: Die Schmieden der Infrastruktur

Deutschland hat sich in dieser Konsolidierungsphase als einer der resilientesten Standorte in Europa bewiesen, getragen von vier essenziellen Hubs. Berlin verteidigt dabei seinen Status als unangefochtene Hauptstadt für FinOps und B2B-Zahlungsinfrastruktur, massiv befeuert durch die Talent-Pipelines der TU Berlin sowie das dichte Netzwerk an Serial Entrepreneurs aus der N26- und SumUp-Schule. Frankfurt am Main bildet den unverzichtbaren regulatorischen Gegenpol; hier, im Schatten von EZB und BaFin, entstehen im Umfeld des TechQuartiers und der Frankfurt School of Finance and Management jene Start-ups, die komplexe Compliance- und Treasury-Architekturen für Großbanken bauen. München dominiert den Bereich DeepTech und Embedded Insurance im industriellen B2B-Kontext, was auf die herausragende Stellung des Center for Digital Technology and Management (CDTM) und die enge Verzahnung mit der ansässigen Versicherungs- und Automobilindustrie zurückzuführen ist. Hamburg schließlich hat sich als europäischer Hotspot für Trade Finance und in Logistikketten eingebettete Finanzierungen etabliert, gestützt durch die traditionelle Stärke der Hansestadt im globalen Handel.

Investor*innen-Radar

Das Ökosystem der Geldgeber*innen hat sich im Jahr 2026 stark differenziert und professionalisiert. An der Spitze der spezialisierten VCs agieren Fonds wie FinTech Collective und Motive Ventures (hervorgegangen aus der Übernahme des Berliner VCs embedded/capital), die mit tiefem technologischen Verständnis gezielt in Infrastruktur-Layer investieren. Unter den Top-Tier Generalisten ragen Cherry Ventures, Earlybird und Point Nine heraus, die insbesondere Series-A-Runden bei überzeugenden B2B-SaaS-Modellen anführen.

Ein starker Motor sind zudem Corporate VCs und bankennahe Fonds geworden: CommerzVentures, als unabhängiger Player, treibt Themen wie Climate-Fintech massiv voran, während CVCs der Realwirtschaft wie Allianz X und Porsche Ventures strategisch in Start-ups investieren, die sich nahtlos in ihre eigenen vertikalen Ökosysteme einklinken lassen. In der kritischen Frühphase wird der Markt von einer hochgradig vernetzten Gruppe aus Business Angels angetrieben, die nicht nur erstes Kapital, sondern vor allem regulatorisches Know-how und entscheidende Bankennetzwerke einbringen

Die Top Start-ups (Must-Watch)

Für die nachfolgende Liste der Must-Watch-Unternehmen haben wir strikte Kriterien angelegt. Die Auswahl basiert auf nachgewiesener Marktrelevanz durch echte Kund*innenimplementierungen, einem hohen technologischen Reifegrad und einem diversifizierten Ansatz bei der Lösung komplexer Finanzinfrastrukturprobleme. Zudem war ein nachhaltiges Investoren-Vertrauen in den letzten zwölf Monaten ein Schlüsselfaktor. Wir beleuchten hierbei ausschließlich Start-ups mit Hauptsitz in Deutschland, deren Gründung im Jahr 2020 oder später erfolgte, um die wahre nächste Generation der Branche abzubilden.

Banxware

Das 2020 von Miriam Wohlfarth und Jens Röhrborn gegründete Banxware hat sich als Marktführer für Embedded Lending in Deutschland etabliert. Banxware bietet eine White-Label-Lösung, mit der Marktplätze und Zahlungsdienstleister*innen ihren Händler*innen Sofortkredite basierend auf historischen Umsatzdaten anbieten können. Der USP liegt in der extrem schnellen Risikoprüfung und der nahtlosen API-Integration in bestehende Plattformen. Das enorme Vertrauen der Finanzbranche in dieses Modell spiegelt sich massiv auf Investor*innenseite wider: Neben frühen Leadern wie Element Ventures (heute 13books Capital) ist insbesondere der Einstieg der Großbank UniCredit ein Ritterschlag. Die Bank führte nicht nur die Series-A-Runde an, sondern legte Mitte 2025 mit einem weiteren strategischen Millionen-Investment nach, um die europäische Expansion von Banxware gemeinsam voranzutreiben.

Pliant

Im Jahr 2020 von Malte Rau und Fabian Terner aus der Taufe gehoben, definiert Pliant den Markt für B2B-Kreditkarten und Ausgabenmanagement neu. Das B2B-SaaS-Modell kombiniert eine moderne Karteninfrastruktur mit einer tiefen API-basierten Integration in Buchhaltungs- und ERP-Systeme. Der technologische Vorsprung liegt im eigenen Card-as-a-Service-Angebot (CaaS), das anderen B2B-Plattformen den Launch eigener Kreditkartenprogramme ermöglicht. Ein entscheidender Meilenstein war hierfür der Erhalt der eigenen E-Geld-Lizenz der BaFin, die Pliant die nötige regulatorische Unabhängigkeit verleiht. Unterstützt wird Pliant von namhaften Investoren wie SBI Investment, Alstin Capital – und einem Investment des globalen Schwergewichts PayPal Ventures, das das enorme Skalierungspotenzial der Plattform bestätigt.

Mondu

Die Serial Entrepreneurs Malte Huffmann, Philipp Povel und Gil Danziger gründeten Mondu 2021 und revolutionieren damit den B2B-Zahlungsverkehr. Ihr B2B-BNPL-Modell ermöglicht es Geschäftskund*innen, online wie B2C-Kund*innen auf Rechnung oder in Raten zu kaufen, während der Händler sofort sein Geld erhält. Die Kerntechnologie ist ein proprietäres Echtzeit-Risk-Scoring für Firmenkund*innen. Finanziert wurde diese Vision anfangs von Top-Tier-Fonds wie Valar Ventures und Cherry Ventures. Der ultimative Ritterschlag erfolgte jedoch Ende 2025: Neben dem Erhalt der E-Geld-Lizenz sicherte sich Mondu eine 100-Millionen-Euro-Fazilität von J.P. Morgan Payments inklusive einer strategischen Partnerschaft, um die Buy-Now-Pay-Later-Lösung dem europäischen Kund*innen stamm der US-Großbank anzubieten.

Payrails

Gegründet 2021 von Orkhan Abdullayev, Emre Talay und Nicolas Thouzeau, löst Payrails die Herausforderung der Payment Orchestration. Das FinOps-Start-up baut ein intelligentes Betriebssystem für Zahlungen, das Transaktionen für Enterprise-Kund*innen dynamisch über verschiedene Provider routet, um Kosten zu senken und Autorisierungsraten zu maximieren. Die technologische Brillanz dieser Architektur lockte früh Schwergewichte wie Andreessen Horowitz und EQT Ventures an. Im Sommer 2025 zündete Payrails die nächste Stufe: HV Capital führte eine massive Series-A-Runde über 32 Millionen US-Dollar an, bei der auch alle Top-Tier-Altinvestoren erneut mitzogen, um die globale Expansion der Plattform endgültig zu sichern.

Finmid

Die beiden N26-Alumni Max Schertel und Alexander Talkanitsa starteten Finmid 2021 mit der Mission, jede B2B-Plattform zu einer Finanzierungsquelle zu machen. Ihr Geschäftsmodell fokussiert sich auf Embedded B2B Lending, das speziell auf die Anforderungen von Marktplätzen (wie etwa dem Partner Wolt) zugeschnitten ist – ohne dass diese Plattformen eigenes Kapital bereitstellen oder Risiken tragen müssen. Ihr USP ist die radikale Simplifizierung der B2B-Kreditvergabe durch smarte Echtzeit-Datenverknüpfungen. Angetrieben von einer wuchtigen 23-Millionen-Euro-Series-A-Runde, angeführt vom britischen Fonds Blossom Capital und dem Seed-Lead Earlybird, treibt das Start-up seine aggressive europäische Expansion unaufhaltsam voran.

Topi (Exit)

Charlotte Pallua und Estelle Merle brachten Topi 2021 an den Start, um das Hardware-as-a-Service-Modell in den B2B-Bereich zu integrieren. Über die Plattform können B2B-Kund*innen IT-Equipment flexibel mieten, wobei Topi den gesamten Prozess vom Checkout über das Refinancing bis zum Asset-Management abwickelt. Nachdem Topi mit Händler*innen wie Cyberport massiv skalierte und von Top-VCs wie Index Ventures und Creandum finanziert wurde, erfolgte im Sommer 2025 der strategische Exit: Das FinTech wurde von dem internationalen Leasing-Giganten PEAC Solutions (einem BlackRock-Portfoliounternehmen) übernommen, um das innovative B2B-Mietmodell global in dessen gewaltige Finanzierungsinfrastruktur einzugliedern.

Hakuna

Im Bereich Embedded Insurance schlägt das 2021 von Sebastian Jost, Rupert Mayer und Orhan Köroglu gegründete Hakuna neue Wege ein. Das Start-up bietet Händler*innen eine Plattform für Garantieverlängerungen und Produktschutzversicherungen, nahtlos integriert in den Online- und Offline-Checkout. Der USP ist ein völlig neu gedachtes, digitales Schadensmanagement, das die Abwicklung für Endkund*innen radikal vereinfacht. Finanziert von Top-VCs wie Earlybird und Visionaries Club, hat Hakuna mittlerweile den Sprung ins absolute Enterprise-Segment geschafft: Im Jahr 2025 integrierten Branchenriesen wie Vorwerk, STIHL und Mister Spex die Embedded-Technologie des Start-ups, um ihre eigenen, maßgeschneiderten Produktschutzprogramme europaweit zu skalieren.

Pile (Exit)

Jessica Holzbach startete Pile 2022 und pivotierte das Modell nach dem Krypto-Winter erfolgreich zu einem hochspezialisierten Treasury-Angebot für Start-ups. Die B2B-SaaS-Technologie bündelte Konten und automatisierte die Diversifikation von Einlagen zur Risikominimierung. Das Modell erregte schnell Aufmerksamkeit und führte bereits im Sommer 2024 zu einem frühen Exit: Die 2019 gegründete Berliner Neobank Vivid Money übernahm das Start-up, um das eigene Business-Banking-Angebot mit Piles Treasury-Technologie aufzurüsten – ein Paradebeispiel für die rasante Konsolidierung im FinTech-Infrastrukturmarkt.

Internationaler Ausblick & Fazit

Blickt man über die Grenzen Europas hinaus, formen sich 2026 drei gewaltige Makro-Trends, die den deutschen Markt unausweichlich verändern werden. Aus Asien schwappt die Architektur für grenzüberschreitende Echtzeit-Settlements basierend auf regulierten Stablecoins und digitalen Zentralbankwährungen heran, was das traditionelle Korrespondenzbankensystem massiv unter Druck setzt. Die USA hingegen dominieren die Entwicklung der KI-gesteuerten autonomen Finanzen, bei der das Corporate Treasury von Algorithmen gesteuert wird, die ohne menschliches Zutun Liquidität verschieben. Aus Indien lernen wir, wie Identity-as-a-Service untrennbar mit dem Zahlungsverkehr verschmilzt und Betrug nahezu ausmerzt.

Für Gründer*innen und Investor*innen im DACH-Raum bedeutet dies: Der Fokus muss radikal auf Profitabilität, wasserdichter Compliance und extrem stabiler Infrastruktur liegen. Wer heute in Embedded Finance gewinnt, baut keine bunten Apps mehr, sondern die hochkomplexen, unsichtbaren Stahlträger der digitalen Weltwirtschaft.

Wenn das Team zum Flaschenhals wird: Warum Start-ups oft an „Ghost Positions“ scheitern

Schnelles Wachstum birgt Risiken: Wachsen Teams nicht mit, entstehen toxische „Ghost Positions“. Ex-Tibber-Deutschland-Chefin Marion Nöldgen erläutert im Interview, wie Gründer*innen gegensteuern.

Schnelles Wachstum – die sogenannte Hypergrowth-Phase – ist das ultimative Ziel und oft die wichtigste Metrik nach einer erfolgreichen Finanzierungsrunde. Doch genau im Moment des größten Triumphs lauert eine der gefährlichsten Fallen für junge Unternehmen: Das Start-up skaliert rasant, aber die Menschen und die internen Strukturen kommen nicht mehr hinterher.

Die Folgen dieses mangelhaften „People Scalings“ werden oft viel zu spät erkannt und können das Wachstum empfindlich bremsen. Ein typisches Symptom sind sogenannte Heritage Hires: Mitarbeitende der ersten Stunde, die aus Loyalität und Historie plötzlich in große C-Level- oder VP-Rollen hineingewachsen sind, denen sie fachlich oder führungstechnisch (noch) nicht gewachsen sind. Ignoriert die Geschäftsführung dieses Problem, reagiert das System von selbst – es entstehen „Ghost Positions“. Im Schatten des offiziellen Organigramms bilden sich heimliche Parallelstrukturen, um eigentlich zuständige, aber überlastete oder überforderte Führungskräfte schlichtweg zu umgehen.

Wie Gründer*innen diese tückischen Wachstumsfallen rechtzeitig erkennen und proaktiv auflösen, weiß die Clearimpact-Gründerin Marion Nöldgen. Als Expertin für Organizational Design und zertifizierte Aufsichtsrätin kennt sie die Wachstumsschmerzen schnell skalierender Unternehmen aus erster Hand. In den vergangenen zehn Jahren hat sie als Geschäftsführerin mehrere Start-ups aufgebaut, internationalisiert und durch extreme Wachstumsphasen geführt – unter anderem die deutsche Tochter des GreenTech-Unternehmens Tibber, den bekannten Pionier für dynamische Stromtarife.

Im StartingUp-Interview erklärt sie, warum die meisten Businesspläne nicht am Markt, sondern am falschen Team-Setup scheitern, wie man schwierige Gespräche mit loyalen Mitarbeitenden der ersten Stunde führt und wie ein Organisationsdesign aussehen muss, das echtes Wachstum aushält.

Marion, du hast in den letzten zehn Jahren zahlreiche Unternehmen gegründet, internationalisiert und in absolute Hypergrowth-Phasen begleitet. Wenn du auf diese Zeit zurückblickst: Was war dein größtes Learning in Bezug auf das Team-Wachstum?

Marion Nöldgen: Dass Wachstum nicht daran scheitert, dass man zu wenig gute Leute hat – sondern daran, dass man sie nicht richtig einsetzt.

In frühen Phasen funktioniert viel über Intuition, Vertrauen und Geschwindigkeit. Das trägt einen ziemlich weit. Aber irgendwann kippt das System. Rollen werden größer, Anforderungen komplexer – und plötzlich reicht es nicht mehr, dass jemand „gut ist“. Er oder sie muss auch schnell genug mit einer Rolle mitgewachsen sein.

Gleichzeitig verändert sich die Struktur selbst. Was am Anfang gebraucht wurde, gibt es in dieser Form später oft gar nicht mehr – oder es kommen komplett neue Anforderungen dazu, für die es vorher schlicht keine Rolle gab.

Mein größtes Learning: Man muss nicht nur die richtigen Leute holen und halten, sondern auch Rollen aktiv weiterentwickeln – und beides immer wieder neu aufeinander abstimmen. Sonst wächst das Unternehmen, aber die Organisation hält nicht mit.

In deiner aktuellen These triffst du einen wunden Punkt: Du sagst, die meisten Businesspläne scheitern nicht am Markt, sondern am falschen Team. Warum wird das People Scaling – im Gegensatz zum Skalieren von Produkt oder Vertrieb – von Gründer*innen oft so stiefmütterlich behandelt?

Marion Nöldgen: Weil es deutlich unangenehmer ist.

Produkt, Vertrieb, Zahlen – das ist rational. Da kann ich Hypothesen testen, optimieren, Entscheidungen treffen. Beim Team geht es um Menschen, Beziehungen, Loyalität und offene Konflikte. Da wird es erstens schnell persönlich und zweitens dauert es oft lange, bis die Probleme überhaupt sichtbar werden. Schlechte Produktentscheidungen merkt man relativ schnell. Schlechte Teamentscheidungen oft erst Monate später – wenn Strukturen schon verhärtet sind.

Viele hoffen dann, dass es sich „einfach einspielt“. Tut es aber meistens nicht.

Lass uns über ein sehr sensibles Thema sprechen: Heritage Hires. Oft wachsen Mitarbeiter der ersten Stunde plötzlich in Führungspositionen (z.B. als VP oder Head of) hinein, für die sie eigentlich (noch) nicht bereit sind. Ab wann wird Loyalität hier zum Wachstumsrisiko für das Unternehmen?

Marion Nöldgen: In dem Moment, in dem die Rolle mehr verlangt, als die Person leisten kann – und man es trotzdem laufen lässt. Loyalität ist extrem wertvoll. Gerade in der Anfangsphase. Aber sie ist kein Ersatz für Erfahrung oder Führungsfähigkeit.

Das Risiko entsteht nicht dadurch, dass jemand noch nicht so weit ist – das ist normal. Es entsteht, wenn man weder Rolle noch Besetzung anpasst, obwohl beides längst nicht mehr zusammenpasst.

Die menschliche Komponente ist hier extrem schwierig: Wie gehe ich als Gründer*in oder CEO das Gespräch mit einem hochverdienten Heritage Hire an, wenn ich merke, dass die Rolle zu groß geworden ist, ohne diese Person zu demotivieren oder gar ans Unternehmen zu verlieren?

Marion Nöldgen: Indem man Rolle und Besetzung klar trennt – und genau so ins Gespräch einsteigt. Also nicht über die Person sprechen, sondern über die Rolle: Was muss sie aktuell liefern? Und wo stehen wir heute? Oft ist die Lücke ziemlich offensichtlich – und auch, dass sie nicht realistisch zu schließen ist. Gleichzeitig sollte klar gemacht werden: Es geht nicht darum, die Person zu verlieren. Im Gegenteil – man möchte sie halten und gemeinsam schauen, in welcher Rolle sie künftig wirklich wirksam sein kann.

Die meisten spüren das selbst längst. Was fehlt, ist die klare, ehrliche Ansprache.

Wenn das sauber gemacht wird, stehen die Chancen gut, dass die Person bleibt – nur eben in einer für sie und das Unternehmen wirksamen Rolle.

Ignoriert man das Problem der überlasteten Führungskräfte, entstehen laut dir sogenannte Ghost Positions und Parallelstrukturen. Woran erkenne ich als Geschäftsführung rechtzeitig, dass mein Team anfängt, das eigentliche Organigramm heimlich zu umgehen? Gibt es typische Red Flags?

Marion Nöldgen: Ja, ziemlich klare sogar.

Entscheidungen dauern ungewöhnlich lange – oder werden plötzlich woanders getroffen. Themen „wandern“ durch die Organisation, bis sie jemand entscheidet.

Du siehst, dass Leute sich bewusst andere Ansprechpartner suchen als die eigentlich zuständige Führungskraft. Oder dass Dinge einfach selbst gelöst werden, um voranzukommen.

Das sind alles Signale dafür, dass die formale Struktur nicht mehr mit der Realität übereinstimmt.

Wenn das Kind bereits in den Brunnen gefallen ist und sich Ghost Positions etabliert haben – wie löst man diese Schattenstrukturen wieder auf, ohne dass das operative Geschäft zusammenbricht?

Marion Nöldgen: Auf jeden Fall nicht alle auf einmal!

Der erste Schritt ist Transparenz: sichtbar machen, wie Entscheidungen aktuell tatsächlich getroffen werden. Das ist oft schon ein Augenöffner.

Dann geht es darum, Verantwortung wieder sauber zuzuordnen – und konsequent dorthin zurückzugeben. Das braucht Zeit und Kommunikation.

Und ehrlich gesagt: In manchen Fällen kommt man nicht darum herum, auch personell etwas zu verändern. Alles andere ist Kosmetik.

Als Expertin für Organizational Design: Wie muss eine Unternehmensstruktur aufgebaut sein, die einerseits flexibel genug für die typische Start-up-Agilität ist, andererseits aber stark genug, um Phasen extremen Wachstums (z.B. nach einer Series A oder B) auszuhalten?

Marion Nöldgen: Sie muss klarer sein, als viele denken – aber nicht komplizierter.

Was es braucht, sind klare Rollen, klare Entscheidungswege und ein gemeinsames Verständnis davon, wer für was verantwortlich ist.

Flexibilität entsteht nicht durch Unklarheit, sondern dadurch, dass alle wissen, wo sie sich bewegen können. Wenn das fehlt, wird jede Veränderung anstrengend.

Wie bindet man Weiterbildung und Leadership-Training in ein Umfeld ein, in dem eigentlich immer die Devise „Execution first“ gilt?

Marion Nöldgen: Indem man es auch genau so behandelt: als Teil der Arbeit – nicht als Extra. Ich bin kein großer Fan von Wochenend-Workshops oder theoretischen Trainings „on top“. Gerade in frühen Wachstumsphasen bringt das wenig.

Entscheidend ist Training on the job. Das heißt konkret: Lernen passiert im Alltag. In echten Meetings, echten Entscheidungen, echten Situationen. Genau dort kann man direkt Feedback geben – zum Beispiel, wenn ein Teammeeting unklar geführt ist oder Erwartungen nicht sauber formuliert werden.

Es geht weniger um Theorie und mehr darum, in der konkreten Arbeit besser zu werden.

Zum Abschluss: Wenn du einem Gründungsteam, das gerade ein großes Funding abgeschlossen hat und kurz davor steht, sein Team zu verdreifachen, nur einen einzigen Rat mit auf den Weg geben dürftest – welcher wäre das?

Marion Nöldgen: Schaut euch ehrlich in die Augen und fragt euch: Was müssen wir konkret liefern, um das, was wir gepitcht haben, wirklich umzusetzen? Also: Welchen Output muss jede einzelne Rolle erzeugen – nicht high level, sondern ganz konkret, was ist das Ergebnis dieser Arbeit?

Wer verantwortet welchen Teil – und kann die Person das auch leisten?

Und wenn nicht, muss man es ansprechen. Früh. Und mittelfristig wahrscheinlich etwas verändern.

Danke, Marion, für die spannenden Insights!

Das Interview führte StartingUp-Chefredakteur Hans Luthardt

Nicht nur pitchen, auch ankommen: Was ein professioneller Auftritt auf Events und Messen ausmacht

Auf Messen zählt für Start-ups mehr als nur der Pitch. Ein souveräner Auftritt gelingt erst durch Struktur, Vorbereitung und das richtige Umfeld.

Wer als junges Unternehmen auf Events, Messen oder Branchentreffen unterwegs ist, denkt oft zuerst an den eigentlichen Auftritt. Pitch, Präsentation, Gespräche am Stand, Networking oder ein Termin mit potenziellen Partnern stehen schnell im Mittelpunkt. Im Alltag zeigt sich aber, dass der professionelle Eindruck viel früher beginnt. Er entsteht nicht erst in dem Moment, in dem gesprochen wird, sondern schon in der Art, wie gut ein Termin vorbereitet ist, wie ruhig ein Tag abläuft und wie stimmig einzelne Programmpunkte ineinandergreifen.

Gerade Start-ups unterschätzen diesen Punkt leicht. In frühen Phasen wird vieles parallel organisiert. Produkt, Kommunikation, Kundentermine und operative Aufgaben laufen ohnehin gleichzeitig. Wenn dann noch ein Event oder eine Messe dazukommt, wird häufig vor allem auf Inhalte geachtet. Das greift aber zu kurz. Denn ein überzeugender Auftritt hängt nicht nur davon ab, was gesagt wird, sondern auch davon, unter welchen Bedingungen dieser Auftritt stattfindet.

Ein guter Eventtag beginnt nicht erst vor Publikum

Viele Termine außer Haus wirken von außen kompakt, sind intern aber erstaunlich dicht. Anreise, Check-in, Abstimmung im Team, Material, Gespräche vor Ort, spontane Kontakte, kurze Pausen und Nachbereitung greifen oft ineinander. Wenn diese Übergänge nicht sauber geplant sind, entsteht unnötige Reibung. Dann fehlt Konzentration genau in den Momenten, in denen ein Unternehmen besonders präsent wirken sollte.

Für Gründerteams ist das relevant, weil auf Messen und Events oft mehrere Ziele gleichzeitig verfolgt werden. Sichtbarkeit, Kundengewinnung, Netzwerke, Partnergespräche und Marktbeobachtung laufen parallel. Wer in diesem Umfeld professionell wirken will, braucht nicht nur gute Inhalte, sondern auch einen Ablauf, der Stabilität gibt.

Warum der Gesamteindruck mehr ist als Pitch und Outfit

Ein professioneller Auftritt wird oft zu eng verstanden. Viele denken dabei an Kleidung, Präsentationsmaterial oder das Gespräch selbst. Tatsächlich wirkt aber der gesamte Rahmen mit. Wer gehetzt ankommt, Unterlagen spontan zusammensucht oder zwischen Programmpunkten keine klare Struktur hat, verliert schnell Wirkung. Umgekehrt kann ein klar organisierter Tag dafür sorgen, dass auch kurze Kontakte souveräner und verbindlicher erscheinen.

Das ist gerade für Start-ups wichtig, weil sie häufig nicht mit Größe, sondern mit Klarheit, Präsenz und Verlässlichkeit punkten müssen. Auf Events zählt nicht nur der Inhalt, sondern auch das Gefühl, das ein Gespräch hinterlässt. Wirkt ein Team vorbereitet? Ist es ansprechbar, ohne hektisch zu sein? Kann es zwischen verschiedenen Terminen professionell umschalten? Solche Faktoren entscheiden mit darüber, wie ein junges Unternehmen wahrgenommen wird.

Mehrtägige Formate brauchen einen besseren Rahmen

Besonders deutlich wird das bei Messen oder Veranstaltungen, die nicht nach zwei Stunden vorbei sind. Wer über mehrere Programmpunkte, Tage oder Abendtermine hinweg präsent sein muss, braucht mehr als nur eine Anreiseoption. Dann geht es darum, wie sich ein Ablauf tragen lässt, ohne dass die Qualität des Auftritts im Laufe des Tages spürbar sinkt.

Wenn rund um Messen, Pitches oder Vor-Ort-Termine mehrere Programmpunkte zusammenkommen, kann ein modernes Hotel Nürnberg den professionellen Rahmen eines solchen Auftritts sinnvoll ergänzen. Der Mehrwert liegt dabei nicht in Übertreibung, sondern in Nutzbarkeit. Wer zwischen Terminen kurz zurückkehren, sich sortieren, Material anpassen oder den nächsten Programmpunkt vorbereiten kann, arbeitet meist klarer. Gerade bei jungen Unternehmen, in denen oft wenige Personen viele Rollen gleichzeitig übernehmen, ist das ein echter Vorteil.

Vorbereitung endet nicht mit der Anreise

Viele Eventtage scheitern nicht an mangelnder Motivation, sondern an zu wenig Struktur. Deshalb lohnt es sich, vorab einfache Fragen sauber zu klären. Welche Termine sind wirklich entscheidend? Wo braucht es bewusst freie Zeitfenster? Wer übernimmt welche Gespräche? Welche Unterlagen müssen jederzeit griffbereit sein?

Solche Punkte wirken unscheinbar, haben aber direkten Einfluss auf die Außenwirkung. Wer vorbereitet wirkt, schafft schneller Vertrauen. Wer im Ablauf ruhig bleibt, kann auch im Gespräch überzeugender auftreten. Gerade auf Messen, wo viele Eindrücke gleichzeitig auf Besucher und Aussteller einwirken, macht diese Form von Klarheit einen spürbaren Unterschied.

Auch das Umfeld beeinflusst den Auftritt

Ein weiterer Punkt wird oft übersehen: Der Ort rund um einen Termin beeinflusst mit, wie konzentriert und professionell ein Tag abläuft. Das gilt nicht nur für die Messehalle oder den Veranstaltungsraum selbst, sondern auch für alles davor und danach. Wo wird vorbereitet? Wo wird nach einem Gespräch noch kurz sortiert? Wo kann ein Team den Tag sinnvoll strukturieren?

Auch ein stilvolles Hotel Düsseldorf wird dort interessant, wo Geschäftstermine, Veranstaltungen und Vorbereitung nicht isoliert, sondern als zusammenhängender Arbeitsablauf gedacht werden.

Gerade in solchen Zusammenhängen zeigt sich, dass professionelle Präsenz mehr ist als reine Sichtbarkeit. Sie entsteht dort, wo Inhalt, Ablauf und Umfeld zusammenpassen. Hotels wie das Cloud One passen deshalb gut in dieses Bild, wenn junge Unternehmen einen Messe- oder Eventtag nicht nur absolvieren, sondern strukturiert und professionell aufsetzen wollen.

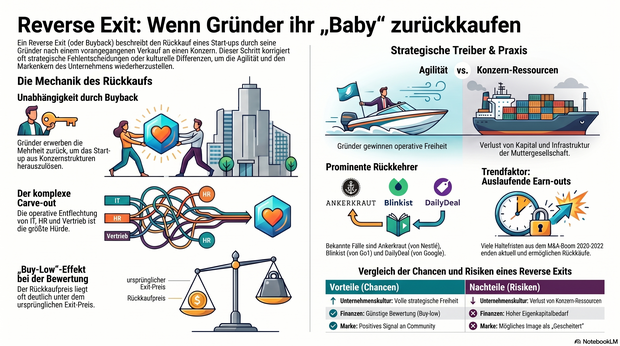

Reverse Exit: Wenn der Exit den Rückwärtsgang einlegt

In jüngster Zeit häufen sich in der Start-up-Szene Fälle, in denen Gründer*innen ihr Lebenswerk nach einem Exit überraschend zurückkaufen. Wir zeigen, was es mit dem Reverse Exit auf sich hat.

Für die meisten Gründer*innen ist er das ultimative Ziel auf der Start-up-Reise: der Exit. Doch was passiert, wenn die Traumhochzeit mit dem Konzern oder dem/der Großinvestor*in im Alltagstresor der Konzernstrukturen erstickt? Der sogenannte Reverse Exit rückt in den Fokus – und wirft für angehende wie gestandene Gründer*innen die Frage auf, ob ein Verkauf wirklich immer das Ende der eigenen Unternehmensgeschichte sein muss.

Was ist ein Reverse Exit?

Ein Reverse Exit (oft auch als Buyback oder Management Buyout / MBO nach einem vorherigen Verkauf bezeichnet) beschreibt den Vorgang, bei dem die ursprünglichen Gründer*innen oder das Managementteam die Mehrheit oder alle Anteile ihres Start-ups von dem/der bisherigen Käufer*in zurückerwerben. Das Start-up wird dadurch aus den Strukturen des Konzerns oder der Investor*innengruppe herausgelöst und agiert wieder als eigenständiges, unabhängiges Unternehmen.

Motivation der Beteiligten: Warum die Rolle rückwärts?

Ein Reverse Exit geschieht selten aus einer Laune heraus. Er ist zumeist das Ergebnis eines Reifeprozesses, bei dem beide Seiten erkennen, dass getrennte Wege wirtschaftlich und strategisch sinnvoller sind.

- Motivation der Gründer*innen (Käufer*innen): Oft prallen nach einem Exit die agile Start-up-Kultur und starre Konzernprozesse schmerzhaft aufeinander. Gründer*innen wollen die operative Entscheidungsgewalt zurückerlangen, eine verwässerte Markenidentität retten oder das Unternehmen schnell auf neue Markttrends (wie aktuell künstliche Intelligenz) ausrichten, was im Konzerngeflecht schlicht zu lange dauern würde.

- Motivation der Corporates (Verkäufer*innen): Konzerne trennen sich meist wieder von ihren Zukäufen, wenn das Start-up die erhofften Synergien nicht bringt oder die Umsätze nach der Übernahme stagnieren. Manchmal ändern sich auch die strategischen Kernziele des Mutterkonzerns, sodass das Start-up als „Non-Core-Asset“ wieder abgestoßen wird.

Vor- und Nachteile eines Reverse Exits

Der Rückkauf des eigenen „Babys“ mag romantisch klingen, ist wirtschaftlich aber ein enormer Kraftakt. Die wichtigsten Aspekte im Überblick:

Aspekt | Vorteile (Chancen) | Nachteile (Risiken) |

Unternehmenskultur | Volle strategische Freiheit und Rückbesinnung auf den ursprünglichen Markenkern | Verlust der Konzern-Ressourcen (Kapital, Vertriebsnetzwerk, Infrastruktur) |

Finanzen | Chance auf eine günstige Unternehmensbewertung beim Rückkauf (Buy-low-Effekt) | Hoher Kapitalbedarf für den Erwerb und das anschließende operative Geschäft |

Image & Marke | Starkes, positives Signal an die Community und Mitarbeiter („Wir sind wieder da“) | Reputationsrisiko bei künftigen B2B-Partner*innen, möglicher „Gescheitert“-Stempel |

Neben diesen offensichtlichen Punkten gibt es weitere, tieferliegende Schmerzpunkte, die bei einem Buyback zwingend auf dem Schirm sein müssen:

- B2B-Kund*innen und „Change of Control“-Klauseln: Große Enterprise-Kund*innen arbeiten oft gern mit Start-ups zusammen, weil im Hintergrund ein bonitätsstarker Konzern steht. Fällt dieses Sicherheitsnetz weg, greifen in Verträgen oft sogenannte Change of Control-Klauseln. Diese räumen den Kun*innen ein Sonderkündigungsrecht ein, weshalb wichtige Großkund*innen oft mühsam neu verhandelt werden müssen.

- Die Mitarbeitendenperspektive & ESOPs: Bei einem Exit werden Mitarbeitendenbeteiligungsprogramme (ESOPs/VSOPs) oft ausbezahlt und verfallen danach. Beim Rückkauf fängt das Start-up in Sachen Mitarbeitenden-Incentivierung oft wieder bei null an. Zudem bedeutet der Wegfall der Konzernstrukturen für manche Mitarbeitenden einen Verlust an Sicherheit (z.B. keine Konzern-Boni mehr), was den Buyback zu einem massiven HR-Kraftakt macht.

- Wem gehört das IP? (Geistiges Eigentum): Die Herauslösung von Patenten, Code oder Markenrechten, die während der Konzernzugehörigkeit entwickelt wurden, ist ein rechtliches Schlachtfeld. Gründer*innen müssen absichern, dass sie wirklich die uneingeschränkten Rechte an ihrem eigenen Produkt zurückkaufen.

Wie geht ein Reverse Exit vonstatten?

Der Prozess eines Rückkaufs ist oft deutlich komplizierter als der ursprüngliche Exit, da das Start.up bereits administrativ in den Konzern integriert wurde. Ein typischer Ablauf vollzieht sich in vier Schritten:

- Initiierung und Sondierung: Zumeist nach strategischen Differenzen oder Umstrukturierungen im Konzern treten die Gründer*innen mit einem Übernahmeangebot an den Eigentümer*innen heran.

- Unternehmensbewertung: Eine neue Due Diligence ist notwendig. Da das Wachstum im Konzern oft stagnierte oder Markenwerte gelitten haben, liegt der Kaufpreis häufig deutlich unter der damaligen Exit-Bewertung.