Aktuelle Events

Studie zur Skepsis der Deutschen gegenüber neuen Technologien

Big Data, Blockchain und Co.: Wir Deutschen offenbaren grobe Wissenslücken bei neuen Technologien. Der 2. Teil der repräsentativen Maisberger-Umfrage zeigt einen fatalen Zusammenhang zwischen fehlendem Wissen und Technik-Skepsis auf.

Kaum jemand hierzulande kann Big Data, Blockchain oder Immersive Media erklären – weder oberflächlich noch tiefgreifend. Das zeigt der zweite Teil der repräsentativen Studie „Die Skepsis der Deutschen gegenüber neuen Technologien“. Das Marktforschungsinstitut YouGov führte die Umfrage im Auftrag der Kommunikationsagentur Maisberger unter mehr als 2.000 Teilnehmern durch. Abgefragt wurden insgesamt zehn digitale Technologien. Die Ergebnisse legen nahe: Fehlendes Wissen und Skepsis hängen eng zusammen.

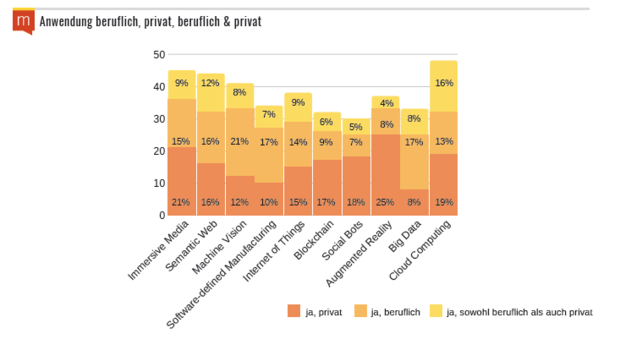

Der erste Teil der Studie drehte sich um die Frage, ob Technologien wie Big Data vom Namen her bekannt sind und bewusst im Beruf oder im privaten Alltag genutzt werden. Im zweiten Teil der Studie ging es darum, wie gut die Studienteilnehmer über Technologien Bescheid wissen, von denen sie bereits gehört haben. Geklärt werden sollte, ob sie sich zutrauen, diese zumindest oberflächlich oder vielleicht sogar tiefgreifend zu erklären?

Status quo: Keine oder nur flüchtige Kenntnisse

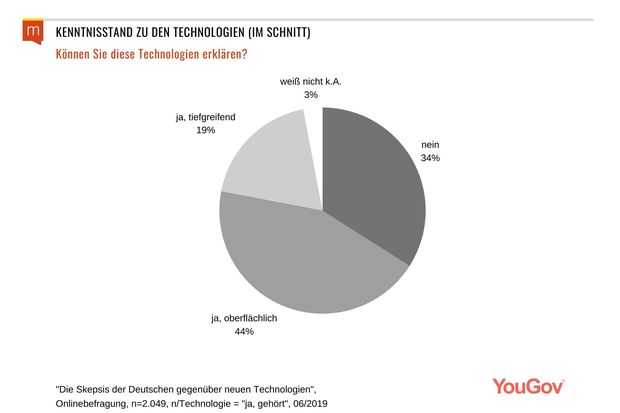

Ein Resultat: Technologien, die den Studienteilnehmern vom Namen nach geläufig sind, können im Schnitt zu 34 Prozent gar nicht und zu 44 Prozent nur oberflächlich erklärt werden. Tiefgreifende Kenntnisse sind nur zu 19 Prozent vorhanden. Alles in allem überwiegen bei den Befragten also Wissenslücken.

Was aber bedeutet oberflächliches Wissen konkret? „Wer eine Technologie oberflächlich erklären kann, hat diese bewusst wahrgenommen und erste Infos dazu abgespeichert. Wir können davon ausgehen, dass die Betreffenden eine grobe Vorstellung davon haben, um was es geht und wo die Technologie möglicherweise zum Einsatz kommt“, so Dr. Alexander Pschera, Geschäftsführer der Kommunikationsagentur Maisberger. Tiefgehendes Wissen hingegen umfasst profunde Kenntnisse zur Funktionsweise, zu Anwendungsfeldern oder Einsatzmöglichkeiten. Dr. Pschera weiter: „Auch Informationen zu den möglichen Folgen gehören dazu – wie etwa zu erwartende Nutzerzahlen, Effizienzsteigerungen sowie politische und gesellschaftliche Auswirkungen.“

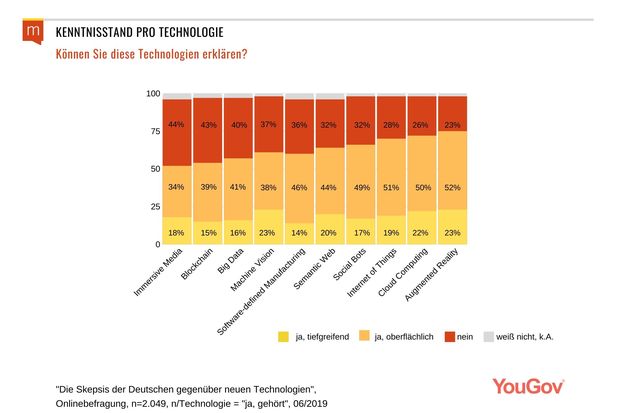

Top 3: Augmented Reality, Cloud Computing und Internet of Things

Wie genau wissen die Deutschen also über die einzelnen Technologien Bescheid? Laut Umfrage ist der Wissensstand für Augmented Reality am höchsten. Insgesamt können 75 Prozent der Befragten, denen die Technologie bekannt ist, auch etwas dazu sagen – zu 52 Prozent oberflächlich, zu 23 Prozent tiefgreifend. Ähnlich verhält es sich bei Cloud Computing: 72 Prozent wissen, um was es sich dabei handelt (50 Prozent oberflächlich, 22 Prozent tiefgreifend). Beim Internet of Things sind es insgesamt 69 Prozent (51 Prozent oberflächlich, 19 Prozent tiefgreifend).

Schlusslichter: Immersive Media, Blockchain und Big Data

Am größten ist die Wissenslücke bei den Themen Immersive Media (44 Prozent), Blockchain (43 Prozent) und Big Data (40 Prozent). „Gerade bei Blockchain hätten wir uns mehr erwartet“, so Dr. Pschera weiter. „Die Datenbank-Technologie ist eine Art gemeinsam genutztes und öffentliches Buchungssystem, mit dem sich Kryptowährungen wie Bitcoin umsetzen lassen. Blockchain ist also die Grundvoraussetzung für die im Internet äußerst beliebte Zahlungsmethode. Die Technologie kann aber beispielsweise auch für die lückenlose Dokumentation von Lieferketten oder für sichere Online-Wahlen eingesetzt werden.“

Auch das schlechte Ergebnis für Big Data gibt Dr. Pschera zu denken. „Aus unserem Alltag ist Big Data – also die Erfassung, Verarbeitung, Speicherung und Analyse großer Datenmengen – nicht mehr wegzudenken. Nur so können wir beispielsweise auf Shopping-Portalen Kaufempfehlungen erhalten oder im Straßenverkehr von modifizierbaren Ampelphasen profitieren.“

Resümee: Zusammenhang zwischen Desinteresse, Unwissenheit und Skepsis

Die Studienergebnisse zeigen: Ein Großteil der deutschen Bevölkerung kann mit digitalen Technologien nichts anfangen. „Es fehlen das Interesse und die Motivation, sich mit Themen wie Big Data, Immersive Media oder Blockchain auseinanderzusetzen. Fatal ist, dass die allgemeine Skepsis der Deutschen gegenüber neuen Technologien auf Unwissenheit beruht. Für eine fundierte und differenzierte Meinungsbildung muss man schließlich wissen, worum es geht“, resümiert Dr. Pschera.

Gründer*in der Woche: Brotrausch – Premium-Teig im recycelten Messbecher

Backen ohne Frust: Wie Brotrausch mit smarten Premium-Mischungen im recycelbaren Messbecher den hart umkämpften DIY-Brotmarkt aufmischen will.

Hinter der 2022 ins Leben gerufenen Marke Brotrausch, die 2023 offiziell an den Start ging, steht heute die Bremer Brot GmbH. Das Unternehmen hat die Marke im Jahr 2025 durch einen Asset Deal übernommen. An der Spitze des Start-ups steht ein Gründer, dessen Wurzeln weit abseits des klassischen Bäckerhandwerks liegen. Philipp Herrnberger, einst in der Sportvermarktung bei Werder Bremen tätig, gründete nicht aus einer entspannten Laune heraus, sondern aus gesundheitlichen Gründen. Nach dem Konsum von herkömmlichem Industrie-Brot kämpfte er immer wieder mit Beschwerden. Sein Antrieb: Ein bekömmliches, transparentes Brot ohne Zusatzstoffe zu kreieren, das man ohne Vorwissen einfach selbst backen kann.

Der Sprung aus der Agenturwelt in die Food-Szene war unkonventionell, doch genau das habe dem Team geholfen, „Dinge anders zu denken“, erinnert sich Herrnberger. In der ersten Phase finanzierte sich das anfänglich fünfköpfige Gesellschafterteam komplett aus eigenen Mitteln. Der Mix aus Bäckermeister, Kaufmann und Kreativen brachte dabei entscheidende Vorteile: „Wir konnten uns voll auf Produkt und Marke konzentrieren, ohne von Anfang an von externen Erwartungen getrieben zu sein“, erklärt der Geschäftsführer. Dennoch räumt er rückblickend offen ein, dass der Bootstrapping-Ansatz an seine Grenzen stieß. „Unter dem Strich muss man sagen, dass wir es ohne externe Investoren nicht geschafft haben“, resümiert Herrnberger über den rettenden Asset-Deal und Neustart im Sommer 2025.

Premium-Teig im recycelten Messbecher

Das Geschäftsmodell hebt sich bewusst vom preissensiblen Massenmarkt ab und richtet sich an all jene, denen im Post-Corona-Alltag schlichtweg die Zeit für aufwändige Sauerteig-Experimente fehlt. Hier setzt das Start-up mit absoluter Convenience an: Die neun natürlichen Brotmischungen erfordern laut Hersteller keinerlei Backerfahrung, kommen gänzlich ohne Küchenmaschine aus und beschränken sich auf rund zehn Minuten aktive Arbeitszeit. Die Zutaten für die „Made in Germany“-Strategie stammen aus kontrolliertem, regionalem Anbau.

Raffiniert und praktisch zugleich ist die Verpackungslösung: Die Mischungen ruhen in einem PET-Becher, der direkt als exakter Messbecher für die benötigte Wasserzugabe dient. Doch gerade ein Plastikbecher weckt in der nachhaltigkeitsgetriebenen Zielgruppe oft Skepsis. Herrnberger verteidigt die Entscheidung leidenschaftlich und verweist auf das rigorose Ausschlussverfahren in der Produktentwicklung. „Kraftpapiertüten sehen offensichtlich nachhaltig aus, wenn sie aber wie für uns beschichtet wären, können sie nur noch verbrannt werden“, kontert der Gründer. Dies sei überhaupt nicht im Sinne der Ressourcenschonung. Stattdessen setzt Brotrausch auf einen vollständig aus recyceltem PET bestehenden Becher einer deutschen Firma. Da die Pappbanderole raffiniert „einschnappt“ und nicht geklebt wird, seien beide Komponenten zu 100 Prozent wiederrecycelbar. Damit sei die Marke auch fit für zukünftige rechtliche Verpackungsvorschriften.

Smarte Nischen und margenstarkes Upselling

Anstatt den oft verlustreichen Preiskampf im regulären Supermarktregal zu suchen, etabliert sich Brotrausch konsequent als D2C-Marke im Premium-Segment. Eine reguläre Brotbackmischung schlägt mit 5,99 Euro zu Buche – eine echte Ansage für ein Produkt, in das die Kundschaft noch Strom, Wasser und Arbeitszeit investieren muss.

„Auf den ersten Blick wirkt der Preis natürlich hoch, vor allem, wenn man ihn rein mit Mehl vergleicht“, gibt Herrnberger zu bedenken. Dieser Vergleich greife jedoch zu kurz. „Wir verkaufen kein Rohprodukt, sondern ein durchdachtes Gesamterlebnis“, betont er und verweist auf die raffinierten Rezepturen und Prozesse, die zu einem Resultat führen, „das viele so zuhause sonst nicht hinbekommen würden“. Die Preisakzeptanz misst das Unternehmen primär über das Feedback und das Kaufverhalten. Als Kund*innen begannen, nicht nur ein zweites Mal zu bestellen, sondern direkt größere Pakete und mehrere Sorten in den Warenkorb legten, wusste das Team: Der Markt akzeptiert den Premium-Aufschlag. Zudem stellt Herrnberger klar: „Im Übrigen kostet das Backen im heimischen und relativ neuen Backofen keine 25 Cent.“

Aus den regulären Supermärkten hat sich Brotrausch mittlerweile bewusst zurückgezogen, da der Kampf um die Regale dort stark über den Preis diktiert wird. „Wir fokussieren uns nun auf Genusspartner wie Weinhändler, Hofläden oder Feinkosthändler, bei denen die Preise hochwertiger Produkte eher akzeptiert werden“, erklärt der Geschäftsführer den strategischen Kurswechsel.

Um die ambitionierte Preisgestaltung zu rechtfertigen, inszeniert das Start-up seine Produkte gezielt als Lifestyle-Upgrade – etwa für das autarke Vanlife beim Camping, als Mitbringsel zum Grillen oder für den Osterbrunch. Flankiert wird das Kernsortiment durch ein lukratives Upselling-Portfolio, das von stilvollen Geschenkboxen für knapp 30 Euro bis hin zu speziellen Baguette-Backblechen, Fruchtaufstrichen und Stullensalzen reicht. Diese Zusatzartikel seien laut Herrnberger zwar nicht essenziell für das Überleben des Unternehmens, da das Brotbacken der Mittelpunkt bleibe, sie seien aber entscheidend für das Wachstum. „Im E-Commerce geht es um den durchschnittlichen Warenkorb und die Retention“, analysiert der Gründer. Das Zusatzsortiment mache das „Erlebnis Brot“ noch intensiver. Der Umsatzanteil dieser lukrativen Extras liegt aktuell bei knapp 15 Prozent.

Die Gretchenfrage der Kund*innenbindung

Dieser strategische Ansatz sichert gesunde Margen und entzieht die Marke geschickt der Vergleichbarkeit mit Discountern. Dennoch bleibt eine große Herausforderung: Der Markt für DIY-Lebensmittel ist durch starke Bio-Traditionsmarken massiv umkämpft. Die größte Hürde besteht darin, die Wiederkaufsrate auf einem profitablen Niveau zu halten. Denn wenn die stylische Mischung primär als originelles Präsent zum Vatertag verschenkt wird, fehlen dem Unternehmen am Ende die wiederkehrenden Alltagsumsätze.

Einen aggressiven Rollout in den stationären Einzelhandel schließt Herrnberger vorerst aus. Dies sei nur mit hohen Investitionen machbar und berge das Risiko, zu einem „One-Hit-Wonder“ zu verkommen. Die Devise lautet stattdessen: „Wir wollen gesund wachsen, um profitabel zu werden.“ Die Geschenkboxen spielen in dieser Strategie eine überraschende Doppelrolle. Sie treffen nicht nur den Zeitgeist, sondern fungieren als cleverer Akquise-Kanal. „Wir erreichen dadurch Menschen, die uns vielleicht noch nicht kennen und unmittelbar mit der Marke, der Qualität und dem Erlebnis in Berührung kommen“, freut sich Herrnberger. Auf diese Weise spare man sich enorme Kund*innenakquisitionskosten. Zudem entwickle sich das Geschenke-Segment zunehmend zu einem echten Profitcenter im B2B-Bereich – etwa wenn Immobilienmakler die Boxen zur Hausübergabe als modernes „Brot und Salz“-Präsent nutzen.

Trotz der starken Nischen-Performance ist klar: Brotrausch muss langfristig beweisen, dass das Premium-Brot aus dem Becher nicht nur an Feiertagen verschenkt wird, sondern den dauerhaften Sprung in die alltägliche Frühstücksroutine der Konsument*innen schafft.

Primogene: 4,1 Mio. Euro für den Muttermilch-Code – Deep-Tech-Innovation oder riskantes Unterfangen?

Das Leipziger BioTech-Start-up Primogene hat eine Seed-Finanzierung in Höhe von 4,1 Mio. Euro eingesammelt, um komplexe bioaktive Moleküle im industriellen Maßstab auf den Markt zu bringen.

Während die Unternehmenskommunikation den Durchbruch einer neuen Plattformtechnologie feiert, zeigt ein genauerer Blick auf den globalen Markt für humane Milcholigosaccharide (HMOs) ein Haifischbecken voller multinationaler Konzerne. Eine kritische Analyse des Geschäftsmodells, der Gründer*innen und des Wettbewerbs.

DeepTech Made in Leipzig

Hinter Primogene stehen Dr.-Ing. Reza Mahour (CEO), Valerian Grote und Linda Karger (COO), die das Unternehmen 2023 in Leipzig gründeten. Die Zusammensetzung des Teams vereint technologische und wissenschaftliche Expertise, um die ehrgeizige Vision einer industriellen Enzym-Produktion umzusetzen. Die aktuelle, 4,1 Millionen Euro starke Seed-Runde wird vom High-Tech Gründerfonds (HTGF) angeführt. Zum Investoren-Konsortium gehören außerdem der Technologiegründerfonds Sachsen (TGFS), better ventures, die Sächsische Beteiligungsgesellschaft (SBG), die Golzern Holding GmbH, die FS Life Science Investment GmbH sowie Dr. Marc Struhalla, Gründer und CEO der c-LEcta GmbH. Der Kapitaleinsatz ist klar definiert: Die neuen Mittel fließen in den Ausbau des IP-Portfolios, die Erweiterung der Produktionskapazitäten in Leipzig und in strategische Partnerschaften.

Das Modell im Stresstest: Die Kostenfalle der Enzyme

Primogene hat eine enzymatische Plattformtechnologie entwickelt, um Inhaltsstoffe zu produzieren, die identisch zu natürlichen Molekülen sind – nachhaltig und kosteneffizient. Im Zentrum stehen dabei komplexe humane Milcholigosaccharide (HMOs) wie Disialyllacto-N-Tetraose (DSLNT) und Difucosyllacto-N-Tetraose I (LNDFH I). Laut Primogene verursachen etablierte fermentative Herstellungsverfahren erhebliche Kosten und stoßen bei der Produktion derartiger hochkomplexer Moleküle an ihre Grenzen.

Der Lackmustest: Die Prämisse, dass enzymatische Verfahren in der Massenproduktion überlegen sind, birgt in der Praxis massive Hürden. Die Entwicklung und wirtschaftliche Produktion der benötigten Enzyme selbst ist extrem kapitalintensiv. Dass das Start-up den gesamten Prozess – von der Enzymentwicklung über die Produktion und Biotransformation bis zur Aufreinigung – komplett am eigenen Unternehmensstandort in Leipzig abbilden will, ist ein ambitionierter, aber riskanter Schritt. Der Aufbau eigener Produktionsanlagen für komplexe BioTech-Prozesse führt oft zu einer enorm hohen Kapitalverbrennungsrate (Burn Rate).

Erste kommerzielle Meilensteine dämpfen dieses Risiko jedoch: Erste Inhaltsstoffe für Kosmetikprodukte wurden mit Kooperationspartnern entwickelt und sind bereits kommerziell erhältlich. Auch pharmazeutische Rohstoffe befinden sich aktuell im Test bei Kund*innen. Zudem erforscht das Unternehmen in Zusammenarbeit mit dem Fraunhofer-Institut für Zelltherapie und Immunologie (IZI) in Leipzig das Potenzial seiner Inhaltsstoffe zur Prävention von Infektionskrankheiten.

Im Haifischbecken: Auf Kollisionskurs mit den Lebensmittel-Riesen

Der Zielmarkt ist hochattraktiv: Der globale HMO-Markt wächst jährlich um etwa 18 bis 20 Prozent, und über 65 Prozent der im Jahr 2023 neu eingeführten Säuglingsnahrungsprodukte enthielten mindestens ein HMO. Neben der Säuglingsernährung bedient Primogene auch Märkte wie die Darmgesundheit bei Erwachsenen, die Gedächtnisverbesserung im Alter sowie funktionale Inhaltsstoffe für Körperpflege und pharmazeutische Rohstoffe.

Das Leipziger Team trifft in der Nahrungsmittelindustrie jedoch auf einen extrem konsolidierten Markt, der von Milliarden-Konzernen dominiert wird. Einer der größten B2B-Zulieferer für Säuglingsnahrung weltweit ist DSM-Firmenich (mit der übernommenen Sparte Glycom), der den Markt durch gigantische Größenvorteile (Economies of Scale) in der Fermentation beherrscht. Auch Chr. Hansen (Jennewein), ein Pionier in der mikrobiellen HMO-Synthese, stellt mit seiner extrem tiefen Integration bei Lebensmittelriesen einen massiven Konkurrenten dar. Auf der Abnehmerseite agieren Endkonsument*innen-Giganten und Branchenführer wie Nestlé und Abbott, bei denen für einen neuen Zulieferer von Inhaltsstoffen extrem hohe regulatorische und volumenbasierte Hürden bestehen.

Primogenes strategische Nische: Ein Preiskampf bei einfach strukturierten Standard-HMOs gegen die großen Fermentations-Player wäre für ein Start-up kaum zu gewinnen. Primogenes entscheidender Wettbewerbsvorteil liegt jedoch in der Komplexität. Die industrielle Produktion von Molekülen wie DSLNT – das laut klinischen Studien signifikante gesundheitliche Vorteile speziell für Frühgeborene bietet – war bislang schlicht nicht möglich. Wenn Primogene hier durch sein starkes Patentportfolio die technologische Lücke schließt, umgeht das Unternehmen den harten Konkurrenzkampf im Massenmarkt.

Unser Fazit: Hohes Risiko, riesiger Hebel

Primogene ist kein schlankes Software-Projekt, sondern waschechtes DeepTech. Das bedeutet: Hohe regulatorische Hürden, langer Atem in der Forschung und massive Kapitalanforderungen. Die Seed-Finanzierung in Höhe von 4,1 Millionen Euro ist ein starker Vertrauensbeweis erfahrener Investoren, wird für den Anlagenbau und die Skalierung der Leipziger Produktion auf Dauer jedoch kaum ausreichen. Primogene muss nun rasch beweisen, dass die enzymatische Synthese nicht nur technologisch überlegen, sondern auch unter realen industriellen Kostendrücken skalierbar ist. Gelingt dieser Proof of Concept, hält das Start-up den Schlüssel zu einer neuen Generation komplexer, bioaktiver Moleküle in der Hand.

Cyber-Souveränität als Geschäftsmodell: QuoIntelligence sichert sich 7,3 Mio. Euro für den europäischen Markt

Regulierung als Wachstumstreiber: Das Frankfurter Cyber-Security-Start-up QuoIntelligence sammelt in seiner Series-A-Finanzierungsrunde 7,3 Millionen Euro ein. Das Versprechen: Hochwertige, fertig analysierte Cyber-Bedrohungsdaten speziell für den europäischen Mittelstand. Doch wie skalierbar ist der Spagat zwischen KI-Automatisierung und menschlicher Analyse, wenn man gegen etablierte US-Giganten antritt?

Der Weg von QuoIntelligence ist eng mit der Biografie seines Gründers Marco Riccardi verknüpft. Riccardi verbrachte sieben Jahre tief im IT-Sicherheitsapparat des Frankfurter Finanzsektors: Von 2013 bis 2015 war er als IT-Security-Berater für die Europäische Zentralbank (EZB) tätig, gefolgt von zwei Jahren als Threat Intelligence Analyst bei der Deutschen Bank. Vor der Gründung von QuoIntelligence Anfang 2020 leitete er zudem die Intelligence Operations beim Frankfurter Unternehmen QuoScient.

Heute führt Riccardi das Start-up mit einem europäisch aufgestellten Management-Team, dem unter anderem David Brown (UK), Antonio Arias Lopez (Deutschland), Odín Rodríguez Lago (Spanien) und Marina Gómez Lara (Spanien) angehören.

„Finished Intelligence“ statt roher Daten-Feeds

QuoIntelligence positioniert sich als Anbieter für „Unified Risk Intelligence“. Das Kernproblem vieler Unternehmen: Der Aufbau eines eigenen Cyber-Intelligence-Teams erfordert oft sechsstellige Investitionen allein für Fachpersonal. QuoIntelligence verspricht hier Abhilfe durch „Finished Threat Intelligence“ – fertig analysierte und kontextualisierte Bedrohungsinformationen, die innerhalb weniger Stunden einsatzbereit sind, ohne dass der Kunde ein eigenes internes Expertenteam benötigt.

Technologisch stützt sich das Unternehmen dabei auf zwei Säulen:

- Mercury: Die hauseigene Plattform aggregiert Erkenntnisse aus über 1.000 Quellen und nutzt eine kuratierte Wissensbasis von über 17.000 geprüften Intelligence-Tickets.

- KARLA: Ein konversationeller KI-Analyst soll diese komplexen Informationen für alle Unternehmensebenen – vom Vorstand bis zum Sicherheitsanalysten – zugänglich machen.

Das Modell stößt auf eine beachtliche Marktresonanz: Für das Jahr 2025 meldet das Startup keinen einzigen Kundenabgang (Zero Client Churn). Zudem hat sich der Customer Lifetime Value seit 2023 beinahe versechsfacht. Ein weiterer Vertrauensbeweis ist die Rolle als offizieller ENISA-Anbieter mit einem Vierjahresvertrag über 1,4 Millionen Euro seit Februar 2025.

Der Wachstumsmotor: NIS2, DORA und Daten-Souveränität

Die aktuelle Finanzierungsrunde wird von Elevator Ventures (Raiffeisen Bank International) angeführt und von der BMH Beteiligungs-Managementgesellschaft Hessen co-geführt. Beteiligt sind zudem eCAPITAL und Mercurius Private Equity. Dass hier vor allem Kapital mit starken Wurzeln im Finanzsektor fließt, ist strategisch logisch.

Der entscheidende Markttreiber sind die EU-Richtlinien NIS2 und DORA. Allein NIS2 erfasst europaweit über 160.000 Organisationen – davon über 30.000 in Deutschland – und führt zur persönlichen Haftung der Geschäftsführung bei Versäumnissen. Gleichzeitig fordern europäische Beschaffungsrahmen zunehmend, dass sensible Daten innerhalb der EU verbleiben. Hier zieht QuoIntelligence seinen entscheidenden Burggraben:

- Das Unternehmen ist nach deutschem Recht gegründet.

- Sämtliche Intelligence-Daten werden auf deutschem Boden unter EU-Recht gespeichert.

Die Herausforderungen

Trotz der strategisch klugen Positionierung gibt es Hürden:

- Skalierbarkeit: Das Modell setzt auf einen „Analyst-first“-Ansatz, bei dem Experten jede Information prüfen. Bei massivem Wachstum durch neue Vertriebskanäle muss die KI KARLA beweisen, dass sie diese Expert*innen effizient entlasten kann.

- Globale Konkurrenz: US-Schwergewichte wie CrowdStrike oder Mandiant verfügen über weit größere globale Daten-Netzwerke. QuoIntelligence setzt hier voll auf den Trumpf der „europäischen Souveränität“, um sich abzugrenzen.

- Mittelstands-Trägheit: Ob der Mittelstand über die reine Compliance-Erfüllung hinaus tatsächlich in tiefgehende Risiko-Intelligence investiert, wird das langfristige Wachstumstempo bestimmen.

Unser Fazit

QuoIntelligence zeigt sehr anschaulich, wie man Regulierung (NIS2/DORA) als stärksten Vertriebskanal nutzt. Die Wahl der Investor*innen aus dem Finanzsektor sichert den Zugang zur Kernzielgruppe. Mit der klaren Kante beim Datenschutz („Made in Germany“) besetzt das Start-up eine Nische, die für regulierte Unternehmen in Europa zur Pflicht wird. Gelingt der Spagat zwischen menschlicher Expertise und technischer Skalierung, könnte Frankfurt hier einen dauerhaften Champion der europäischen Cybersicherheit hervorbringen.

Vom Assekuradeur zum Cyber-Abwehrzentrum: Baobabs riskante Wette auf die All-in-One-Lösung

Es ist ein mutiger Schritt für ein junges Unternehmen: Das 2021 in Berlin gegründete InsurTech Baobab Insurance streift sein reines Versicherungs-Image ab und firmiert ab sofort unter dem Namen Baobab Risk Solutions (BRS). Zeitgleich führt das Start-up einen eigenen Managed Detection and Response (MDR) Service ein. Damit will das Unternehmen künftig nicht mehr nur den finanziellen Schaden bei Cyberangriffen abfedern, sondern die Angriffe selbst aktiv abwehren. Ein ambitionierter Plan, der das Geschäftsmodell unter enormen Leistungsdruck setzt.

„Unser neuer Name ist ein Versprechen an den Markt: Wir bieten keine bloßen Policen, sondern eine ganzheitliche Strategie gegen digitale Risiken“, erklärt Mitgründer und Geschäftsführer Vincenz Klemm. Prävention, Abwehr und Versicherung sollen fortan eine untrennbare Einheit bilden. Auf die Vermutung, das reine Versicherungsgeschäft sei für den Mittelstand schlichtweg zu unprofitabel geworden, kontert der Gründer deutlich: „Der Wechsel zu Risk Solutions ist weit mehr als ein neues Branding. Damit lösen wir unser Gründungsversprechen konsequent ein.“ Die bloße Police sei nie das Endprodukt gewesen, der Schritt zum aktiven Abwehrdienstleister sei von Tag eins an auf der Roadmap gestanden. Klemm fasst die neue Ausrichtung in einem klaren Kernsatz zusammen: „Wir warten somit nicht darauf, dass ein Schaden reguliert werden muss. Wir sorgen stattdessen aktiv dafür, dass er gar nicht erst entsteht.“ Dies sei kein Ausstieg aus der Versicherung, sondern die Evolution zum echten Risikomanagement für den Mittelstand und Industrieunternehmen.

Vom Millionen-Exit zum Cyber-Schutzschild

Um die Ambitionen von Baobab Risk Solutions zu verstehen, lohnt ein Blick auf das Gründer-Duo. Vincenz Klemm (Geschäftsführer) und Anton Foth (CTO) bringen geballte Erfahrung mit. Klemm baute in den USA den digitalen Makler Gabi auf und verkaufte ihn für rund 320 Millionen US-Dollar an Experian, während Foth als ehemaliger CTO von Coya (später Luko) die tiefe technische Expertise für datengetriebene Versicherungsmodelle liefert. Gestartet mit rund 4,2 Millionen US-Dollar Pre-Seed-Kapital, ist das Unternehmen mittlerweile in Deutschland, Österreich und den Benelux-Ländern aktiv.

Der Aufbau eines europäischen Assekuradeurs in den vergangenen fünf Jahren verlief dabei nicht ohne Hürden. „Eine europäische Expansion ist niemals eine reine Blaupause“, räumt Klemm ein. Um regulatorische Fallstricke frühzeitig zu erkennen, setze man gezielt auf lokale Expertise wie den General Manager für die Benelux-Staaten, Tim van Lier. Als größten Trumpf sieht Klemm jedoch die eigene Reaktionsgeschwindigkeit: „Wenn etwas nicht funktioniert, korrigieren wir es binnen Tagen, statt in monatelangen Release-Zyklen zu verharren.“ Auch die Frage nach frischem Kapital für den nun extrem kostenintensiven MDR-Betrieb wischt er routiniert beiseite: Man sei durch die letzte Finanzierungsrunde hervorragend aufgestellt. Sollte man dennoch nachlegen müssen, wisse man Investoren an der Seite, die „bei positiven Trends extrem schnell Kapital mobilisieren können.“

Der neue Vorstoß: MDR und ein 24/7-Defense-Center

Die Argumente für den neuen, zubuchbaren MDR-Service stützen sich auf drastische Marktveränderungen. Laut dem CrowdStrike Global Threat Report 2026 erfolgen 82 Prozent aller Angriffe mittlerweile ohne klassische Schadsoftware, woran Standard-Antivirus-Programme oft scheitern. Baobabs Antwort darauf ist ein rund um die Uhr besetztes Security Operations Center (SOC). Die Ansagen des Start-ups sind selbstbewusst: Mit einer Erkennungsrate von 99 Prozent identifiziere man Bedrohungen bereits in der Entstehungsphase. Die hauseigene Deep-Scan-Technologie arbeite 3,2-mal effektiver als herkömmliche Scans, zudem liege die Angriffsfrequenz bei Bestandskund*innen um 77 Prozent unter dem Marktdurchschnitt. Ergänzt wird das Ganze durch Dark Web Monitoring.

Doch wie kann ein Start-up im Angesicht des globalen Fachkräftemangels in der Cybersecurity personell und technologisch mit staatlich finanzierten Hacker-Syndikaten mithalten? Klemm verweist auf das ambitionierte Umfeld: Weil das Team Kunden aktiv berate und nicht nur stumpf Risiken überwache, habe man sich als Top-Adresse für Talente etabliert. Gleichzeitig gibt er sich pragmatisch und räumt ein, dass man nicht alles allein stemmen kann: „Um personelle Spitzen abzufangen, kooperieren wir mit hochprofessionellen Technologiepartnern.“ Diese Hybridstrategie sichere die Skalierbarkeit und den Zugang zu führender Technologie. Das absolute Kernversprechen an den Kunden tastet er dabei jedoch nicht an: „Die Analyse und der direkte Kontakt bleiben immer bei uns.“

Genial verzahnt oder überhoben?

In der Theorie ist die Verknüpfung von aktiver Abwehr und Versicherung genial: Versagen die Abwehrmaßnahmen von Baobab, muss die Versicherung den finanziellen Schaden ohnehin tragen – die Interessen von Kund*in und Versicherer sind maximal synchronisiert. In der Praxis gleicht der Betrieb eines 24/7-SOC jedoch einem Hochseilakt, der extrem personal- und kostenintensiv ist. Zudem droht ein massives Klumpenrisiko, falls ein neuartiger Zero-Day-Exploit die Filterlogik umgeht und hunderte Mittelständlerinnen gleichzeitig kompromittiert werden.

Auf dieses „All-Eggs-in-One-Basket“-Szenario angesprochen, reagiert Klemm unaufgeregt und verweist auf die harten Realitäten der Branche: „In der Cybersecurity gibt es keine hundertprozentige Sicherheit. Daher stellt ein neuartiger Zero-Day-Exploit für die gesamte Branche grundsätzlich ein Kumulrisiko dar.“ Doch genau dieses Risiko trage man als Assekuradeur über die Policen ohnehin bereits. Der MDR-Service sei kein zusätzliches Risiko, sondern ein Schutzschild. „Anstatt die Gefahr zu vergrößern, reduziert unsere aktive Abwehr die Wahrscheinlichkeit, dass ein solches Ereignis überhaupt zum Tragen kommt“, argumentiert der Geschäftsführer. Und wenn alle Stricke reißen? „Die Versicherungspolice ist der finale Sicherheitsanker für den reinen Risikotransfer“, stellt er klar.

Markt & Wettbewerb: Kampf der Titanen

Im Mid-Market-Segment tritt das Berliner Team gegen globale Giganten wie Munich Re oder spezialisierte Cyber-MGAs wie das US-Einhorn Coalition an. Auch der Markteintritt US-amerikanischer Riesen in Europa beunruhigt Klemm nicht – im Gegenteil: „Der Markteintritt globaler Akteure unterstreicht vor allem eines: Das enorme Potenzial des europäischen Cybermarktes.“

Die Marschroute für die kommenden 12 bis 18 Monate ist klar gesteckt. Man wolle die Verzahnung von Vorfallsreaktion (Incident Response) und MDR weiter vertiefen und die Schadenquote weiter unter den Marktdurchschnitt drücken. Der entscheidende Hebel soll jedoch die Radikalvereinfachung des Versicherungsabschlusses werden. „Unser Ziel: Der Abschluss einer Cyberversicherung oder Vertrauensschadenversicherung muss so einfach werden wie nie zuvor – für Makler und Kunden“, verspricht Klemm. Gegen die übermächtige Konkurrenz will er nicht durch schiere Finanzkraft gewinnen: „Wir gewinnen diesen Wettbewerb nicht über das größte Marketingbudget, sondern über das beste Risikomanagement und die engste Partnerschaft mit dem Mittelstand.“

Für die Branche ist Baobab damit ein spannendes Lehrstück über die Vertikalisierung von Geschäftsmodellen. Schaffen es die Berliner, ihr technologisches Versprechen zu halten, bauen sie eine hochprofitable Cybersecurity-Festung für den europäischen Mittelstand. Scheitert die Technik jedoch an der Realität komplexer Cyberbedrohungen, droht das gesamte Modell unter den eigenen Schadensquoten zu kollabieren. Es bleibt ein riskantes, aber zukunftsweisendes Play.

Energie-Betriebssystem fürs Mehrfamilienhaus: Berliner Start-up VREY sichert sich 3,3 Millionen Euro Seed-Kapital

Das Climate-Tech-Start-up VREY sammelt eine Millionenfinanzierung ein, um sich als zentrales „EnergyOS“ für Vermieter*innen zu etablieren. Doch der Markt ist umkämpft und hält operative Tücken bereit.

VREY (rechtlich firmierend unter RE Joule GmbH ) hat den Abschluss einer Seed-Finanzierungsrunde in Höhe von 3,3 Millionen Euro bekannt gegeben. Angeführt wird die Runde von Rubio Impact Ventures. Als weitere Investor*innen steigen der High-Tech Gründerfonds (HTGF) sowie der Impact-Investor Kopa Ventures ein. Das frische Kapital soll in die Skalierung des aktuell rund 20-köpfigen Teams sowie in die Weiterentwicklung der eigenen Software-Plattform fließen.

Warum PV auf Mietshäusern bisher oft scheiterte

Solaranlagen auf Einfamilienhäusern sind längst ein Erfolgsmodell, doch auf Mehrfamilienhäusern galten sie lange als operativ komplex und wirtschaftlich wenig attraktiv. Der Hauptgrund: Vermieter*innen, die ihren Mieter*innen Strom vom eigenen Dach anbieten wollten, fielen beim klassischen Mieterstrom-Modell schnell in die Pflichten eines vollwertigen Energieversorgers. Sie mussten unter anderem eine Vollversorgung garantieren – also auch dann Reststrom einkaufen und liefern, wenn die Sonne nicht schien. Komplexe Abrechnungsprozesse und teure Messtechnik schreckten zusätzlich ab.

Mit der Einführung der „Gemeinschaftlichen Gebäudeversorgung“ (GGV) entfällt ein Großteil dieser Hürden, insbesondere die Notwendigkeit für Eigentümer*innen, selbst als Energieversorger*innen aufzutreten.

VREY als „EnergyOS“

Genau auf diese regulatorische Neuerung setzt VREY. Das Start-up kombiniert eine automatisierte Abrechnungssoftware mit der Zulassung als zertifizierter Messstellenbetreiber. VREY positioniert sich damit als eine Art Betriebssystem („EnergyOS“) für die Messung, Abrechnung und Steuerung von Energieflüssen im Mehrfamilienhaus.

Die Wertschöpfung ist in der Theorie für alle Parteien lukrativ:

- Vermieter*in: Eine typische 30-kWp-Anlage auf einem Zehn-Parteien-Haus kann laut VREY rund 5.500 Euro an zusätzlichen jährlichen Einnahmen generieren.

- Mieter*in: Bewohner*innen können ihren Strom bis zu 20 Prozent günstiger beziehen, was laut Unternehmensangaben jährlichen Einsparungen von etwa 120 bis 250 Euro entspricht.

Hohes Tempo seit Gründung

Gegründet wurde VREY im Jahr 2024 von Julius Pahmeier und Cedric Jaeger. Das Tempo des Gründerduos ist beachtlich: Laut Unternehmensangaben hat VREY bereits eine dreistellige Anzahl von Projekten in allen 16 Bundesländern umgesetzt. Die Kundschaft reicht von privaten Vermietern bis hin zu großen Immobilienunternehmen und Wohnungsbaugenossenschaften.

Flaschenhälse und Konkurrenzkampf

Der adressierbare Markt für VREY ist mit über 20 Millionen potenziellen Wohneinheiten in Deutschland enorm. Doch das Start-up bewegt sich keinesfalls im luftleeren Raum.

Der Wettbewerb: Die Marktchancen der GGV haben auch andere Player erkannt. Etabliertere Lösungsanbieter wie Einhundert Energie, Metergrid, Pionierkraft oder das zu Enviria gehörende prosumergy adressieren den Markt für dezentrale Energieversorgung teils seit Jahren mit eigenen Hard- oder Softwarelösungen. VREY muss in der Praxis beweisen, dass die eigene Plattform-Architektur der Konkurrenz langfristig überlegen ist.

Operative Hürden: Obwohl die gesetzlichen Rahmenbedingungen verbessert wurden, ist die Umsetzung oft steinig. Branchenverbände wie die Deutsche Gesellschaft für Sonnenenergie (DGS) kritisieren, dass die Umsetzung der GGV in Deutschland derzeit vielerorts an strukturellen Blockaden der klassischen, grundzuständigen Messstellenbetreiber scheitert. Es kommt zu Verzögerungen beim zwingend notwendigen Einbau intelligenter Messsysteme (Smart Meter).

VREY umgeht diesen Flaschenhals clever, indem das Unternehmen selbst als zertifizierter Messstellenbetreiber agiert und sich so autark von lokalen Netzbetreiber*innen macht. Dennoch bleibt eine zweite operative Hürde bestehen: Die Installation der Anlagen. Hier verlässt sich VREY auf lokale, frei wählbare Installationsbetriebe. Das Wachstum des Start-ups korreliert somit unweigerlich mit den Kapazitäten und dem anhaltenden Fachkräftemangel im deutschen Handwerk.

Fazit

VREY zeigt, wie Start-ups durch neue regulatorische Rahmenbedingungen Märkte erschließen können, die vorher als unprofitabel galten. Die Kombination aus Software-Abrechnung und der Lizenz als eigener Messstellenbetreiber ist ein starker USP, um bürokratische Trägheit zu umschiffen. Mit der soliden Seed-Finanzierung im Rücken hat das Team nun den nötigen Spielraum, um im Kampf um die deutschen Mietshaus-Dächer eine entscheidende Rolle einzunehmen – sofern die Koordination mit dem Handwerk reibungslos skaliert.

BRYCK Startup Alliance: Vom Kohlenpott zum Code-Pott

Das Bundesministerium für Wirtschaft und Energie (BMWE) hat mit den exist Startup Factories ein hochambitioniertes Förderprogramm aufgesetzt. Das Ziel: Wissenschaftliche Erkenntnisse sollen schneller und skalierbarer in die Wirtschaft überführt werden. Eines der Leuchtturmprojekte entsteht derzeit im Ruhrgebiet. Wir werfen einen Blick auf den Status quo der BRYCK Startup Alliance, die Macher*innen im Hintergrund und die Frage, was das Konstrukt Gründenden in der Praxis wirklich bringt.

Deutschland habe ein Transferproblem, so die Analyse der Initiatoren. Während die heimischen Universitäten in der Grundlagenforschung weltweit Spitzengeschwindigkeiten fahren, gerate der Motor ins Stottern, sobald es darum gehe, aus diesen Erkenntnissen marktreife Unternehmen zu formen. Genau hier setzen die geförderten exist Startup Factories an. Sie haben den Auftrag, die Quantität und Qualität wissensbasierter Ausgründungen signifikant zu steigern.

Das Silicon Valley der Schwerindustrie?

Geführt wird die BRYCK Startup Alliance, die 2025 als einer der Sieger des exist-Wettbewerbs gekürt wurde, von einem fünfköpfigen Führungsteam um Geschäftsführer Philipp Herrmann. Herrmann, selbst Seriengründer und Investor, soll die Brücke zwischen akademischer Forschung und traditionellen Corporate-Strukturen schlagen. Das Ziel ist gewaltig: Das Ruhrgebiet soll sich zur führenden Modellregion für industrielle Erneuerung in Europa wandeln.

Warum aber ausgerechnet DeepTech und nicht etwa digitale B2B-Software, wo die Einstiegshürden niedriger wären? Herrmann stellt klar: „Weil wir hier nicht die x-te Region bauen sollten, die versucht, ein kleines Silicon Valley zu spielen.“ Das Ruhrgebiet habe andere Stärken, wie eine enorme Dichte an Hochschulen, Industrie und konkreten Anwendungsfeldern. Für ihn liegt die Zukunft Europas nicht in reinen Softwaremodellen, sondern in Feldern wie Energie, Wasserstoff oder industrieller Effizienz. „DeepTech hat für diese Region einen anderen Hebel“, betont er. Wenn hier etwas funktioniere, habe es echte Wirkung auf industrielle Prozesse und neue Wertschöpfung. Sein Fazit für die Region: „Nicht den schnellsten Hype, sondern den nachhaltigsten Umbau.“

Eine beispiellose Allianz – und potenzielle Corporate-Falle?

Das Fundament der Allianz ist massiv: Die Universitätsallianz Ruhr kooperiert mit der RAG-Stiftung und dem Initiativkreis Ruhr, einem Bündnis aus über 70 Konzernen wie E.ON oder RWE. Für Start-ups klinge das theoretisch nach einem Sechser im Lotto. In der Praxis jedoch drohen agile Gründer*innen oft in den bürokratischen Mühlen der Großkonzerne zu ersticken.

Herrmann räumt unumwunden ein: „Die Gefahr besteht absolut.“ Große Unternehmen seien nicht per se schnell, und Konzernprozesse könnten für junge Teams zermürbend sein. Die Allianz setze daher nicht auf bloßes Networking, sondern auf harte Vorsortierung. „Unser Job ist, viel stärker vorzusortieren: Wo gibt es ein echtes Problem? Wo gibt es auf Unternehmensseite jemanden, der das Thema wirklich treiben will?“ Ein echter „Fast Track“ sei am Ende immer ein gut vorbereiteter Prozess. Zwar werde dadurch nicht jede Reibung verschwinden, aber man könne die Wahrscheinlichkeit für erfolgreiche Pilotprojekte massiv erhöhen.

Status quo: Die Realitätsprüfung

Seit dem Start ist viel passiert: Weit über 130 Start-ups haben die Programme bereits durchlaufen. Zudem wurde mit „GF BRYCK Ventures“ ein 10-Millionen-Euro-Fonds für Frühphasen-Investments etabliert. Doch Herrmann gibt zu, dass zwischen Masterplan und Realität oft Welten liegen.

Besonders die Kluft zwischen Universität, Start-up und Konzern habe ihn in der täglichen Arbeit gefordert. Man habe gelernt, dass ein gutes Ökosystem neben einem „Nordstern“ vor allem „sehr viel operative Kleinarbeit an all den zu verändernden Schnittstellen“ benötige. DeepTech sei eben kein Sprint. „Das Ruhrgebiet verändert man auch nicht mit einer großen Überschrift“, so Herrmann. Vielmehr verändere man es Schritt für Schritt durch funktionierende Beispiele.

Der harte Weg aus dem Labor

Zwei der größten „Start-up-Killer“ bei Uni-Ausgründungen sind ungeklärte Patentrechte (IP) und einseitige Teams aus Forschenden ohne Vertriebserfahrung. Herrmann fordert hier bei den IP-Prozessen vor allem Geschwindigkeit und Verlässlichkeit. „Nichts ist schädlicher als Monate der Unklarheit.“

Gleichzeitig legt er den Fokus auf das Matching der Teams. Während die „Nerds“ aus dem Labor für die Technologie unverzichtbar seien, entstehe ein Unternehmen erst, wenn technologische Exzellenz und unternehmerische Kompetenz zusammenkommen. Er plädiert für ein neues Selbstverständnis: „Ich finde auch, wir müssen weg von diesem alten Denken, dass Forschung und Unternehmertum zwei getrennte Welten seien. Im Idealfall ist Unternehmertum der Weg, wie aus guter Forschung Wirkung wird.“

Was kostet die Förderung?

Mit dem neuen Fonds investiert die Allianz bis zu 300.000 Euro in der ganz frühen Phase. Pauschale Deal-Terms gebe es dabei bewusst nicht, da die Situationen der Teams zu unterschiedlich seien. Herrmann betont jedoch ein wichtiges Prinzip: „Frühphasenfinanzierung darf Gründer nicht klein, sondern muss sie handlungsfähig machen.“

Da 300.000 Euro bei DeepTech-Hardware oft nur ein Anfang sind, müsse man das „Valley of Death“ durch breitere Kapitalzugänge schließen. Er sieht hier eine große Aufgabe für ganz Europa: „Wir brauchen mehr geduldiges Kapital und bessere Anschlussfinanzierung für wissenschaftsbasierte Unternehmen.“ Ziel sei es, die Teams so aufzustellen, dass sie auch die nächste und übernächste Runde erreichen können.

Ausblick: Eine Milliarde fürs Ruhrgebiet

Bis 2030 sind die Ziele messbar: 1.000 wissenschaftsbasierte Ausgründungen und eine Milliarde Euro mobilisiertes Risikokapital. Ob das Projekt ein Erfolg wird, mache Herrmann an substanziellen Ergebnissen fest.

„Im Kern werden wir nur dann wirklich Strahl- und Magnetkraft auf europäischer Ebene entwickeln, wenn aus unseren Startups groß skalierte Unternehmen entstehen – wirkliche Unicorns, die Industrien verändern“, kontert er. Man müsse beweisen, dass hier Firmen entstehen, die industrielle Probleme auf Weltklasseniveau lösen. Sein Wunsch für die nächsten vier Jahre: „Dass das kein spannendes Einzelprojekt mehr ist, sondern ein funktionierendes System mit echter Zugkraft.“ Wenn die ersten Teams aus diesem System zu echten Erfolgsgeschichten werden, sei das der stärkste Beleg für den Erfolg.

Factsheet: BRYCK Startup Alliance auf einen Blick

- Offizieller Name: BRYCK Startup Alliance

- Fokus: DeepTech, B2B, industrielle Transformation

- Status: Prämierte exist Startup Factory des BMWE (Entscheidung am 10. Juli 2025)

- Geschäftsführung: Philipp Herrmann, Dr. Christian Lüdtke, Philippa Köhnk, Ersin Üstün, Maximilian Weil-Schimanski

- Wissenschaftliches Rückgrat: Universitätsallianz Ruhr (Bochum, Dortmund, Duisburg-Essen)

- Wirtschaftliches Netzwerk: Initiativkreis Ruhr (über 70 Top-Unternehmen) & RAG-Stiftung

- Finanzierung: GF BRYCK Ventures (10 Mio. Euro Fonds, Tickets bis zu 300.000 Euro)

- Ziele bis 2030: 1.000 Ausgründungen, 200 skalierende DeepTech-Start-ups, 1 Mrd. Euro mobilisiertes Kapital

- Website: bryckstartupalliance.com/de

Brainjo: 2-Mio-EUR-Spritze für die Therapie-Brille

Lange Wartelisten und ein überlastetes Gesundheitssystem: Das Regensburger Start-up brainjo will die Lücken in der klassischen Psychotherapie mit Virtual Reality (VR) schließen.

Das Digital-Health-Start-up brainjo hat erfolgreich eine Seed-Finanzierung in Höhe von zwei Millionen Euro abgeschlossen. Angeführt wird die Finanzierungsrunde vom High-Tech Gründerfonds (HTGF). Zu den weiteren Geldgebern gehören die MEDICE Health Family als strategischer Partner sowie Business Angels, darunter der Regensburger Investor Andreas Weinhut und der Münchner VC better ventures. Mit dem frischen Kapital finanziert das Unternehmen den Start einer klinischen Studie und treibt die Zulassung seiner ersten digitalen Gesundheitsanwendung (DiGA) voran.

Von der Studenten-Idee zum Digital-Health-Start-up

Hinter brainjo steht ein zehnköpfiges, interdisziplinäres Team, das Expertise aus den Bereichen Technologie, Psychologie und Gesundheit vereint. Gegründet wurde die brainjo GmbH im Jahr 2022 mit Sitz in Regensburg. Die Wurzeln des Unternehmens liegen in einem Ausgründungsprojekt der Ostbayerischen Technischen Hochschule (OTH) Regensburg. Die Gründer – allen voran Christian Gnerlich, Alexander Pilling und Constantin Demigha – begannen bereits 2021 in der lokalen TechBase mit der Vision, Gehirntraining durch Virtual Reality greifbar zu machen.

Was als Projekt für generelle "Mental Fitness" startete, hat sich mittlerweile zu einem klinisch fundierten Ansatz im Bereich Digital Health weiterentwickelt. Heute lenken Markus Wensauer (Co-Founder und CEO) und Christian Gnerlich das operative Geschäft, während Alexander Pilling die VR-Entwicklung verantwortet.

Das Produkt: Psychotherapie im Gaming-Gewand

Brainjo entwickelt VR-basierte DiGAs für die Psychotherapie. Diese sollen künftig von Therapeut*innen oder Ärzt*innen verordnet und von den Krankenkassen erstattet werden. Der Ansatz des Start-ups ist es nicht, die klassische Psychotherapie zu ersetzen, sondern die teils gravierenden Versorgungslücken des Systems zu schließen. Patient*innen sollen so von zuhause aus Zugang zu einer immersiven und individualisierten Behandlungsform erhalten.

Die erste Anwendung richtet sich an Kinder mit ADHS und entsteht in direkter Kooperation mit der MEDICE Health Family. Um die oft geringe Therapiemotivation der jungen Zielgruppe zu knacken, setzt brainjo stark auf Gamification. Die Kinder tauchen per VR in virtuelle Welten ein und trainieren dort durch spielerische Elemente Alltagssituationen und kognitive Fähigkeiten. Laut HTGF-Principal Dr. Jörg Traub unterscheidet sich das Start-up genau durch diese Tiefe der Immersion von reinen Software-Lösungen, was einen klinisch relevanten Ansatz darstelle, um die Therapietreue (Adhärenz) signifikant zu steigern.

Der strategische Schachzug von MEDICE

Der Markt für Therapie auf Rezept (DiGA) ist in Deutschland stark umkämpft. Im Segment ADHS formiert sich bereits handfeste Konkurrenz:

- Bei Erwachsenen: Im Sommer 2025 wurde mit der App ORIKO (entwickelt von Takeda und MiNDNET) die erste DiGA für erwachsene ADHS-Patient*innen in das offizielle Verzeichnis des Bundesinstituts für Arzneimittel und Medizinprodukte (BfArM) aufgenommen.

- Im Kinder- und Jugendbereich: Mit hiToco existiert bereits ein etabliertes, Smartphone-basiertes Elterntraining für Kinder zwischen 4 und 11 Jahren (Zulassung ebenfalls Mitte 2025).

Besonders interessant: Hinter hiToco steht die medigital GmbH – eine Tochter der MEDICE Health Family. Der Einstieg von MEDICE bei brainjo ist daher mehr als nur ein finanzielles Investment. Der Pharmakonzern baut sich hier offensichtlich ein lückenloses, digitales ADHS-Ökosystem auf: hiToco für die Schulung der Eltern, brainjo für die direkte VR-Therapie der Kinder.

Unsere Einordnung

Der technologische Ansatz von brainjo ist vielversprechend und adressiert mit langen Wartelisten in der Psychotherapie ein massives gesellschaftliches Problem. Die strategische Einbettung in das MEDICE-Portfolio ist ein cleverer Hebel. Dennoch muss sich das Modell in den kommenden Jahren harten Herausforderungen stellen:

- Die Hardware-Hürde: Anders als eine einfache Smartphone-App erfordert die Lösung von brainjo teure VR-Brillen. Wer bezahlt die Hardware? Krankenkassen übernehmen in der Regel nur die Kosten für die reine DiGA-Nutzungslizenz. Wenn Eltern in Vorleistung gehen müssen oder ein aufwendiges Leih-System etabliert werden muss, verliert die Therapie ihren propagierten skalierbaren und einfachen Zugang.

- Zulassung und Zeitplan: Die Marktzulassung ist erst für 2028 geplant. Im schnelllebigen Start-up-Sektor ist das eine halbe Ewigkeit. Bis dahin muss brainjo mit den frischen zwei Millionen Euro den Betrieb sichern und vor allem die anstehende klinische Studie erfolgreich durchführen. Ohne wasserdichte Evidenzdaten platzt der Traum der BfArM-Zulassung.

- Akzeptanz bei Eltern und Behandler*innen: Eine immersive VR-Welt löst bei Kindern Begeisterung aus – bei Eltern potenziell Skepsis. Das Team muss pädagogisch überzeugend belegen, dass die zusätzliche „Bildschirmzeit“ unter der Brille einen rein therapeutischen Zweck erfüllt und eine ohnehin bestehende Reizüberflutung bei ADHS-Patient*innen nicht noch verstärkt.

Fazit

Brainjo verlässt die ausgetretenen Pfade der 2D-Apps und wagt sich an die hochkomplexe Schnittstelle zwischen VR-Hardware, Gaming und klinischer Therapie. Gelingt der klinische Wirksamkeitsnachweis und lässt sich die Verteilung der Hardware logistisch reibungslos organisieren, könnte das Start-up die Psychotherapie nachhaltig verändern. Bis 2028 bleibt dieses Vorhaben jedoch ein kapitalintensiver Ausdauerlauf.

Synera sichert sich 35 Mio. Euro für die Revolution des Engineerings

Was einst als bionisches Forschungsprojekt begann, ist heute eine der vielversprechendsten europäischen DeepTech-Hoffnungen. Doch wie tragfähig ist die Vision vom „autonomen digitalen Ingenieur“ im stark regulierten Maschinenbau? Ein tieferer Blick auf Gründer, Markt und das Geschäftsmodell.

Die deutsche Industrie steht unter massivem Druck: Internationale Konkurrenz – insbesondere aus Asien –, chronischer Fachkräftemangel und die Notwendigkeit, Entwicklungszyklen drastisch zu verkürzen, zwingen zum Handeln. Generative künstliche Intelligenz (GenAI) gilt als Heilsbringer, doch in der Praxis verpuffen viele Initiativen. Nur etwa 41 Prozent der KI-Prototypen in der Fertigungsindustrie erreichen laut Branchenstudien den produktiven Einsatz. Die Konstruktions- und Entwicklungsabteilungen gelten als stark in Silos organisiert und bis heute schwer automatisierbar.

„Engineering ist das Rückgrat jedes Industrieunternehmens, gehört jedoch nach wie vor zu den am wenigsten digitalisierten und automatisierten Funktionen und war bis vor Kurzem für KI weitgehend unzugänglich“, bringt es Dr. Moritz Maier, Co-CEO von Synera, auf den Punkt.

Genau in diese Lücke stößt sein Unternehmen. Mit einer Series-B-Finanzierungsrunde über 35 Millionen Euro will das Bremer Startup nun international skalieren. Angeführt wird die Runde vom europäischen Wachstumsfonds Revaia, mit starker Beteiligung des UVC Partners Wachstumsfonds sowie Capgemini (über ISAI Cap Ventures). Auch die Bestandsinvestoren Spark Capital, BMW iVentures und Cherry Ventures ziehen wieder mit. Das Signal an den Markt ist deutlich: Engineering Automation wird zum nächsten großen Software-Schlachtfeld.

Von Kieselalgen zur KI-Plattform

Hinter Synera stehen die Gründer Moritz Maier, Daniel Siegel (beide Co-CEO) und Sebastian Möller (Managing Director). Die Ursprungsidee entstand am renommierten Alfred-Wegener-Institut (AWI) in Bremerhaven. Die Gründer forschten dort im Bereich der Bionik und untersuchten die Leichtbaustrukturen von Kieselalgen, um deren evolutionäre Prinzipien auf technische Bauteile zu übertragen.

Aus „Evolutionary Light Structure Engineering“ wurde 2018 die Ausgründung ELISE. Zunächst lag der Fokus auf algorithmusbasiertem Design. Mit der Zeit erkannten die Gründer jedoch ein viel grundlegenderes Problem: Es fehlte nicht an Software für das eigentliche Design, sondern an einer Brücke, die die unzähligen Insellösungen (CAD, Simulation, Materialprüfung) im Engineering-Alltag verbindet. Dies führte zur Neuausrichtung und schließlich zur Umbenennung in Synera – einer Low-Code- und KI-Plattform für Connected Engineering.

Das Geschäftsmodell im Check

Synera betreibt ein klassisches B2B-Plattform-Modell. Anstatt etablierte Platzhirsche im Computer-Aided Design (CAD) zu verdrängen, positioniert sich Synera als übergeordnete Orchestrierungsschicht. Die Software klinkt sich in über 80 bestehende Tools ein.

- Der Werttreiber: Nutzer*innen können komplexe Workflows (z. B. CAD-Modellierung → Simulation → Kostenkalkulation → Designanpassung) als Templates speichern. Das frische Kapital soll laut Moritz Maier nun eine Entwicklung beschleunigen, „bei der KI-Agenten als echte digitale Engineers agieren und komplexe Workflows entlang der gesamten Wertschöpfungskette autonom ausführen.“

- Der Lock-in-Effekt: Wenn ein Industriekonzern seine Kernprozesse auf Synera automatisiert hat, ist die Plattform kaum noch auszutauschen. Die Wechselkosten für den Kunden sind enorm.

- Die Herausforderungen: Das Modell ist technisch hochkomplex. Die ständige Pflege von über 80 API-Schnittstellen zu Drittanbietern bindet gewaltige Entwickler*innen-Ressourcen. Zudem erfordert der Vertrieb in klassische Hardware-Unternehmen lange Sales-Zyklen.

Zwischen RPA und Spezial-CAD

Wettbewerbsumfeld | Marktansatz | Syneras Differenzierung |

Generatives Design (z. B. nTop, Altair) | Fokus auf die Erstellung hochkomplexer, gewichtsoptimierter Bauteile. | Synera generiert nicht nur das Design, sondern automatisiert den Prozess quer durch verschiedene externe Tools. |

Klassische RPA (z. B. UiPath, Zapier) | Hervorragend für kaufmännische Prozesse (HR, CRM, Rechnungen). | Standard-RPA scheitert an den komplexen 3D-Geometrie- und Physikdaten des Engineerings. |

PLM-Systeme (z. B. Siemens, Dassault) | Verwalten den gesamten Produktlebenszyklus und die Daten. | Synera setzt sich auf diese oft schwerfälligen Systeme, um die agilen Arbeitsschritte flexibler zu machen. |

Kritische Einordnung: Vertraut der/die Ingenieur*in der KI?

Synera verweist auf eine Umsatzverdopplung im vergangenen Jahr und über 60 namhafte Kunden, darunter BMW, Airbus, NASA und Miele. Mit dem frischen Kapital steht die Expansion nach Asien, Europa und in die USA an. Dass dieser Wachstumskurs von den Investoren aktiv gestützt wird, betont Benjamin Erhart, General Partner bei UVC Partners: „Wir konnten erleben, wie Synera als zuverlässiger Partner die Transformation des Engineerings gestaltet.“

Doch der Weg zur breiten Durchdringung birgt auch Stolpersteine:

- Das Vertrauensproblem: „Agentic AI“ bedeutet, dass die Software eigenständig Entscheidungen trifft. In sicherheitskritischen Branchen (Luftfahrt, Automotive) herrschen jedoch strikte Compliance-Regeln. Bevor ein KI-Agent autonome Designänderungen an tragenden Bauteilen vornimmt, müssen massive Haftungsfragen geklärt sein.

- Die Pilot-Falle: Viele GenAI-Projekte scheitern auf dem Weg in die Produktion. Die Gefahr für Synera besteht darin, in Innovationsabteilungen stecken zu bleiben, während das operative Kerngeschäft aus Kostengründen an bewährten Methoden festhält.

- Die API-Abhängigkeit: Wer als Brückenbauer*in zwischen Dutzenden Software-Silos agiert, macht sich von den Anbietern abhängig. Sperrt ein großer CAD-Anbieter seine API, trifft dies Syneras Modell im Kern.

Fazit

Synera ist ein exzellentes Beispiel dafür, wie aus akademischer Grundlagenforschung ein hoch skalierbares DeepTech-Produkt werden kann. Der strategische Pivot vom reinen Design-Tool zur prozessübergreifenden Plattform zahlt sich durch die starke Series B nun aus. Gelingt es den Bremern, den eher konservativen globalen Maschinenbau davon zu überzeugen, dass KI-Agenten die menschlichen Ingenieur*innen nicht ersetzen, sondern befähigen, könnte Synera der entscheidende globale Standard im Connected Engineering werden.

Peak Quantum sichert sich 2,2 Mio. Euro für fehlerresistente Qubits

Peak Quantum holt 2,2 Mio. Euro für fehlerresistente Qubits. Wie das Münchner Spin-off mit EU-Förderung gegen die hochgerüstete Konkurrenz antritt.

München wächst weiter als Europas Quanten-Hauptstadt. Das Start-up Peak Quantum schließt seine Pre-Seed-Runde mit 2,2 Millionen Euro ab und positioniert sich im hart umkämpften Deep-Tech-Markt. Der Pitch der Gründer: Fehlerkorrektur direkt in der Hardware. Doch in einem extrem kapitalintensiven Umfeld reicht Geld allein nicht. Wie das Spin-off mit einem cleveren Infrastruktur-Schachzug gegen die hochgerüstete europäische Konkurrenz bestehen will.

Aus der Forschung in die Praxis

Im Jahr 2024 entstand Peak Quantum als Spin-off aus der Forschungsgruppe von Prof. Stefan Filipp am Walther-Meißner-Institut (WMI), das zur Bayerischen Akademie der Wissenschaften gehört. Das Gründungsteam deckt interdisziplinär die gesamte Wertschöpfungskette vom Chipdesign bis zur Systemintegration ab. Zu den Köpfen hinter der Unternehmung gehören Leon Koch (CEO), Alexander Schult (CFO), Dr. Thomas Luschmann (COO), Dr. Max Werninghaus (CSO), Ivan Tsitsilin (Head of Design), Kedar Honasoge (Head of Production) und Daniil Bazulin (Quantum Engineer). Unterstützt wird das junge Unternehmen durch wichtige Säulen des lokalen Ökosystems wie dem Munich Quantum Valley und der UnternehmerTUM.

„Hardware-First“ statt Software-Pflaster

Das aktuell größte Hindernis im Quantencomputing ist das sogenannte Rauschen – die enorme Fehleranfälligkeit der Recheneinheiten (Qubits). Während die Industrie bisher stark darauf setzte, schlicht die Anzahl physikalischer Qubits hochzuskalieren und Fehler nachträglich per Software zu korrigieren, wählt Peak Quantum einen grundlegend anderen Weg. Das Start-up entwickelt supraleitende Prozessoren, deren physikalische Architektur Fehler bereits auf der reinen Hardware-Ebene unterdrückt. Dieser integrierte Fehlerschutz soll die Komplexität des Gesamtsystems drastisch senken und die Entwicklung kommerziell nutzbarer Rechner massiv beschleunigen.

Das Geschäftsmodell & der EU-Infrastruktur-Hebel

Quanten-Hardware ist ein unfassbar teures Pflaster. Mit dem frischen Kapital von Investor*innen wie dem britischen Lead-Investor Cloudberry Ventures, United Founders oder QAI Ventures steigt die Gesamtfinanzierung von Peak Quantum auf gut fünf Millionen Euro. Für den Aufbau eigener Reinräume (CapEx) reicht das kaum. Der strategische Clou des Geschäftsmodells liegt daher in der europäischen Vernetzung: Peak Quantum bezieht öffentliche Fördermittel aus dem EU Chips Act und wurde ausgewählt, die im April 2026 startende Quantenchip-Pilotlinie SUPREME zu betreiben.

Ziel ist es, in Europa eine skalierbare Produktionsumgebung zu etablieren, die langfristig auch für externe Partner geöffnet werden soll. Ein Modell, das es Peak Quantum erlaubt, trotz einer frühen Finanzierungsphase hocheffizient an industrietauglichen Chips zu feilen.

Der Markt & die Konkurrenz

Doch der Markt verzeiht keine Verzögerungen, und München ist längst ein Haifischbecken der Quantentechnologie. Direkt vor der Haustür sitzen Schwergewichte:

- IQM Quantum Computers: Der europäische Platzhirsch für supraleitende Quantencomputer (mit Hauptsitz in Finnland, aber großem Zentrum in München), der kürzlich eine SPAC-Fusion für einen geplanten Milliarden-Börsengang ankündigte.

- planqc: Ein weiteres Münchner Spin-off, das auf neutrale Atome setzt und bereits 2024 eine Series A in Höhe von satten 50 Millionen Euro abschloss.

- Alice & Bob: Auf internationaler Ebene steht besonders das französische Start-up Alice & Bob in direkter technischer Konkurrenz. Die Pariser entwickeln sogenannte Cat Qubits, die ebenfalls hardwareseitig fehlerresistent sind, und kooperieren dabei bereits eng mit Microsofts Quanten-Sparte.

Fazit: Risiko und enorme Chance

Das Board rund um einen ehemaligen Alphabet-X-Advisor sieht in Peak Quantum ein elementares Puzzleteil für ein eigenständiges europäisches Quanten-Ökosystem. Die Investition ist ein klassisches „Deep-Tech-Infrastruktur-Play“.

Dennoch ist eine Pre-Seed-Runde von 2,2 Millionen Euro im Jahr 2026 angesichts der Kapitalausstattung der Konkurrenz eine riskante Wette. Peak Quantum muss durch den Zugang zur SUPREME-Pilotlinie extrem schnell beweisen, dass die fehlerresistente Architektur industriell skaliert und nicht nur im Labor des WMI funktioniert.

Bringt das Team um Leon Koch erste greifbare Pilotprojekte mit Forschungs- und Industriepartnern in den Bereichen Materialforschung, Logistik oder industrieller Optimierung zum Laufen, könnte Peak Quantum zu einem technologischen Flaschenhals werden, an dem in Europa niemand mehr vorbeikommt. Es ist das Paradebeispiel dafür, wie smarte Gründer*innen nicht nur Code oder Hardware schreiben, sondern das System aus Fördergeldern, Pilotlinien und lokaler Forschungsexzellenz maximal zu ihrem Vorteil hebeln.

50 Mio. US-Dollar-Series A-Runde für Berliner FinTech Midas

Das 2024 von Dennis Dinkelmeyer, Fabrice Grinda und Romain Bourgois gegründete Web3-Start-up Midas sammelt 50 Mio. $ ein, um tokenisierte Vermögenswerte sofort liquide zu machen. Das frische Kapital soll primär in die Entwicklung und Skalierung der sogenannten Midas Staked Liquidity (MSL) fließen.

Der Markt für tokenisierte Vermögenswerte (Real World Assets, kurz RWA) wächst rasant, leidet jedoch noch immer an einer strukturellen Hürde: Während Kryptomärkte rund um die Uhr in Echtzeit handeln, sind traditionelle Finanzprodukte im Hintergrund oft an klassische, mehrtägige Abwicklungszyklen gebunden. Wenn Investor*innen ihre Token in liquide Mittel zurücktauschen wollen, kommt es unweigerlich zu Verzögerungen. Genau diese Lücke will das Berliner FinTech Midas nun schließen und hat dafür massiv Kapital aufgenommen.

Wie das Unternehmen heute mitteilte, flossen in einer Series-A-Finanzierungsrunde 50 Millionen US-Dollar (rund 46 Millionen Euro). Angeführt wird die Runde von den Venture-Capital-Firmen RRE Ventures und Creandum. Zu den weiteren Geldgebern zählen namhafte Branchengrößen wie Framework Ventures, Coinbase Ventures sowie der traditionelle Vermögensverwalter Franklin Templeton, der selbst bereits stark im Bereich tokenisierter Anlageprodukte aktiv ist. Mit der aktuellen Runde steigt das Gesamtfinanzierungsvolumen des Start-ups auf knapp 59 Millionen US-Dollar.

Das Gründerteam aus TradFi und Web3

Hinter Midas, das 2024 gegründet wurde, steht ein Team, das tiefes Wissen aus der traditionellen Finanzwelt (TradFi), dem Venture Capital und dem dezentralen Finanzsektor (DeFi) vereint. An der Spitze steht CEO und Mitgründer Dennis Dinkelmeyer, der vor der Gründung im Investment Research bei Branchengrößen wie Goldman Sachs und der Capital Group tätig war. Er bringt das essenzielle Verständnis für die Strukturierung institutioneller Anlageprodukte in die Blockchain-Welt ein.

Ergänzt wird die Führungsriege durch Executive Chairman und Mitgründer Fabrice Grinda. Als Gründungspartner des Investmentfonds FJ Labs gehört Grinda zu den weltweit aktivsten Angel-Investoren. Er steuert neben Kapital und einem enormen Netzwerk auch operative Erfahrung bei, die er unter anderem als Co-Gründer der für über eine Milliarde US-Dollar übernommenen Plattform OLX sammelte. Komplettiert wird das Führungstrio von Mitgründer Romain Bourgois. Der Tech-Experte war fast ein Jahrzehnt in leitenden Produktrollen beim AdTech-Giganten Criteo tätig, bevor er als Head of Product zum US-Konkurrenten Ondo Finance wechselte. Dort leistete er maßgebliche Pionierarbeit bei der Entwicklung und Skalierung der ersten großen tokenisierten US-Staatsanleihen, wie etwa OUSG und USDY.

Fokus auf „Midas Staked Liquidity“ (MSL)

Das frische Kapital soll primär in die Entwicklung und Skalierung der sogenannten Midas Staked Liquidity (MSL) fließen. Dabei handelt es sich um einen dedizierten Liquiditätspuffer, gegen den die firmeneigenen Token (mToken) jederzeit und ohne Wartezeit eingelöst werden können. Für institutionelle Investoren, die Treasury- und Portfolio-Management auf der Blockchain betreiben, ist diese sofortige Liquidität ein entscheidendes Kriterium.

Bisher mussten Rendite-Investoren oft zwischen der sofortigen Handelbarkeit und den Erträgen von DeFi-Protokollen abwägen – MSL soll diesen Kompromiss überflüssig machen. Die Midas-Plattform überführt dafür institutionelle Anlagestrategien, wie etwa Staatsanleihen (mTBILL) oder Basis-Handelsstrategien (mBASIS), in regulierungskonforme Token, die nahtlos in DeFi-Netzwerke wie Morpho oder Pendle integriert werden können. Nach eigenen Angaben hat Midas seit dem Start Token im Gesamtwert von über 1,7 Milliarden US-Dollar emittiert und dabei Erträge in Höhe von 37 Millionen US-Dollar an seine mehr als 20.000 Nutzer ausgeschüttet. Das Fintech finanziert sich dabei über Gebühren, die auf diese erwirtschafteten Renditen erhoben werden.

Die Brücke zwischen Wall Street und Blockchain

„Wir arbeiten auf eine Zukunft hin, in der Investitionen wie das Internet funktionieren: offen, transparent, kombinierbar und standardmäßig zugänglich“, formuliert CEO Dennis Dinkelmeyer den Anspruch des Unternehmens. Vic Singh, General Partner bei RRE Ventures, teilt diese Vision: Die Tokenisierung werde die globalen Kapitalmärkte fundamental verändern, sobald die traditionelle Finanzwelt ihre Infrastruktur vollständig auf die Blockchain verlagere.

Neben der Etablierung von MSL plant Midas, das frische Kapital für die Erschließung weiterer Anlageklassen und den Ausbau von Partnerschaften zu nutzen. Mit dem Einstieg von Schwergewichten wie Franklin Templeton und Coinbase Ventures positioniert sich das 2024 gegründete Unternehmen damit als einer der zentralen Infrastrukturanbieter an der lukrativen Schnittstelle zwischen klassischem Finanzwesen und der Krypto-Ökonomie.

Griff nach den Sternen: Lieferando- und Tier-Mitgründer sammelt 5 Mio. Euro für Solarenergie aus dem All

Das europäische Start-up TerraSpark will sauberen Strom per Funk aus dem Orbit zur Erde schicken. Mit dabei: der Deutsche Matthias Laug, Mitgründer von Lieferando und Tier Mobility, sowie deutsche Investoren. Wir wollten wissen: Wie realistisch ist das ehrgeizige Vorhaben der Tech- und Raumfahrt-Veteranen? Eine Einordnung.

Europas Energieinfrastruktur stößt zunehmend an ihre Grenzen. Während die Internationale Energieagentur (IEA) prognostiziert, dass sich der Strombedarf von Rechenzentren bis 2030 mehr als verdoppeln wird, zeigten großflächige Stromausfälle in Spanien und Portugal zuletzt die Schwächen der heutigen Energiesysteme auf.

Eine radikale Lösung für dieses drängende Problem verspricht nun das 2025 in Luxemburg gegründete Start-up TerraSpark. Das junge Unternehmen hat eine Pre-Seed-Finanzierungsrunde in Höhe von über fünf Millionen Euro erfolgreich abgeschlossen. Zu den Geldgebern zählen neben der Pariser Gesellschaft Daphni und dem Tech-Investor Sake Bosch auch die Angel-Investoren-Allianz better ventures und die Hans(wo)men Group. Ihr gemeinsames Ziel: Weltraumgestützte Solarenergie kommerziell nutzbar zu machen.

Prominente deutsche Wurzeln in einem hochkomplexen Hardware-Projekt

Dass dieses Vorhaben für die hiesige Gründerszene von besonderem Interesse ist, liegt maßgeblich an der personellen Aufstellung. Hinter TerraSpark steht ein Gründertrio, das eine seltene Kombination aus europäischer Raumfahrtexpertise und massiver Skalierungserfahrung vereint. Aus deutscher Sicht sticht hierbei besonders Chief Operating Officer Matthias Laug hervor. Als Mitgründer von Lieferando und Tier Mobility bringt er tiefe Erfahrung im Aufbau und in der Skalierung großer europäischer Plattformunternehmen in das komplexe Projekt ein.

Geführt wird das Team von CEO Jasper Deprez, einem Seriengründer, der zuvor die globale HR-Tech-Plattform Tradler aufbaute. Die zwingend notwendige Raumfahrt-Expertise liefert Chief Technology Officer Dr. Sanjay Vijendran: Er verantwortete bei der Europäischen Weltraumorganisation (ESA) bereits das Solaris-Programm zur weltraumgestützten Solarenergie und war an der Mars Sample Return Mission beteiligt. Auch auf Investor*innenseite ist das deutsche Vertrauen in das Team groß. Tina Dreimann, Gründerin und Geschäftsführerin von better ventures, lobt genau diese Mischung aus europäischer Raumfahrtkompetenz und der Erfahrung, Technologie wirklich zu skalieren.

Erst die Erde, dann das All

Die Vision des Trios ist gewaltig: Solarenergie soll im Weltraum eingefangen und per Funkfrequenz sicher zur Erde übertragen werden. Das Konzept ist in der Theorie bereits seit den 1970er Jahren bekannt, doch erst heute machen sinkende Startkosten sowie technologische Fortschritte in der Satellitenfertigung und Orbitrobotik die Umsetzung wirtschaftlich tragfähig.

Anstatt jedoch das immense Risiko einzugehen und sofort mit gigantischen Systemen im All zu beginnen, wählt TerraSpark bewusst einen schrittweisen Kommerzialisierungs-Ansatz. Das Startup startet auf der Erde mit der Kommerzialisierung funkfrequenzbasierter drahtloser Energieübertragung für industrielle Anwendungsfälle. Mit diesem pragmatischen Schritt sollen Sicherheit, Effizienz und regulatorische Kompatibilität im kleinen Maßstab demonstriert werden, bevor das System in den Orbit skaliert wird. Ein hochrelevanter Markt für diese erste Phase sind netzferne Regionen, die bislang auf Dieselgeneratoren angewiesen sind. Dort liegen die Stromkosten häufig bei etwa 0,70 bis 1,50 Euro pro Kilowattstunde – ein starkes Preissignal, das technologische Alternativen rasch wirtschaftlich attraktiv machen kann.

Um diesen Markt zu erschließen, bereitet das Unternehmen in den kommenden Monaten erste Pilotanwendungen vor, darunter die drahtlose Energieversorgung eines Live-Events. Auch die Roadmap für den Weg ins All steht: Ein erster orbitaler Technologie-Demonstrator ist für das Jahr 2027 geplant, die erste echte Weltraum-zu-Erde-Energieübertragung wird für 2028 anvisiert.

Markt, Wettbewerb & Machbarkeit

Obwohl die Physik hinter der funkfrequenzbasierten Energieübertragung laut CTO Sanjay Vijendran seit Jahrzehnten validiert ist, bleibt die weltraumgestützte Solarenergie ein extrem komplexes Unterfangen. TerraSpark ist auf diesem kapitalintensiven Spielfeld nicht allein. Neben Start-ups wie Virtus Solis aus den USA oder dem neuseeländisch-deutschen Unternehmen Emrod haben auch etablierte Luft- und Raumfahrtgiganten wie Airbus das enorme wirtschaftliche Potenzial längst erkannt und treiben eigene Forschungsprogramme voran.

Kritisch zu hinterfragen bleibt bei all diesen Vorhaben die technische Effizienz der Energieübertragung über gewaltige Distanzen bis hinunter zur Erde. Die Errichtung großflächiger Solarpaneele im Weltall erfordert trotz signifikant sinkender Frachtpreise weiterhin immense Vorabinvestitionen und unzählige Raketenstarts. Zudem muss der internationale regulatorische Rahmen für das Richten von hochkonzentrierten Funkwellen aus dem All auf irdische Empfangsstationen erst noch global abgestimmt werden.

Fazit

Der „Earth-first“-Ansatz von TerraSpark ist ein äußerst kluger, unternehmerischer Schachzug. Er mildert das finanzielle Risiko für die Seed-Investoren ab, demonstriert Technologie greifbar im Kleinen und könnte frühe B2B-Umsätze generieren, lange bevor die erste Hardware ins All fliegt. Dennoch bleibt der Meilenstein-Plan enorm ambitioniert. Matthias Laug und seine Mitstreiter*innen haben in der Vergangenheit zwar eindrucksvoll bewiesen, dass sie digitale und urbane Geschäftsmodelle massiv skalieren können. Der Schritt vom E-Scooter-Verleih zur interplanetaren Energie-Infrastruktur erfordert in den kommenden Jahren jedoch eine völlig neue Dimension der Exekution – und noch deutlich tiefere Taschen der Investor*innen.

Münchner Start-up Isar Aerospace bricht Testflug der „Spectrum“-Rakete aus Sicherheitsgründen ab

Der zweite Testflug der „Spectrum“-Trägerrakete des Münchner Raumfahrtunternehmens Isar Aerospace musste kurz vor der Triebwerkszündung gestoppt werden.

Ursache war nach Unternehmensangaben ein unbefugtes Boot, das in die maritime Sicherheitszone eingedrungen war. Bis das Areal geräumt werden konnte, verstrich das enge Startfenster zwischen 21:00 und 21:15 Uhr. Die Rakete blieb unbeschadet auf der Startrampe.

Sicherheitsmechanismus statt Fehlschlag

In der Raumfahrtbranche wird ein solcher Abbruch (ein sogenannter Scrub) nicht als technologischer Rückschlag gewertet, sondern als Beleg für greifende Sicherheitsmechanismen. Ein erheblicher Unterschied besteht zu einem tatsächlichen Fehlstart, bei dem Hardware verloren geht – wie es beim Erstflug der „Spectrum“ am 30. März 2025 geschah, als die Rakete nach knapp 30 Sekunden wegen eines Ausfalls der Lageregelung ins Meer stürzte.

Da die Rakete dieses Mal keinen technischen Defekt erlitt, werten die Ingenieure den abgebrochenen Countdown als erfolgreichen Härtetest der Bodenanlagen und der automatisierten Betankungsprozesse. Das Team um CEO Daniel Metzler hatte im Vorfeld betont, dass das primäre Ziel der Mission „Onward and Upward“ darin bestehe, kritische Systeme unter operativen Bedingungen zu validieren. Die nun gesammelten Daten fließen direkt in die Vorbereitung des nächsten Versuchs ein.

Die komplexe Logistik eines neuen Startfensters

Wann die „Spectrum“ erneut betankt wird, hängt von einem mehrstufigen Abstimmungsprozess ab. Nach der Sicherung der Rakete muss Isar Aerospace bei den norwegischen Behörden neue Sperrzonen beantragen. Damit Fischer, Frachtschiffe und Fluggesellschaften ihre Routen rechtzeitig anpassen können, müssen offizielle Warnungen für die Schifffahrt (NOTMAR) und den Luftraum (NOTAM) mit entsprechendem Vorlauf herausgegeben werden. Erst wenn diese bürokratischen Hürden genommen sind und Parameter wie das Wetter am Polarkreis übereinstimmen, kann ein neuer Countdown für die Nutzlast – darunter universitäre Kleinsatelliten der TU Berlin, der TU Wien sowie der norwegische FramSat-1 – beginnen.

Warum Andøya? Der strategische Vorteil im hohen Norden

Dass das Münchner Start-up diese logistischen Herausforderungen im hohen Norden auf sich nimmt, anstatt etwa den etablierten europäischen Weltraumbahnhof Kourou in Südamerika zu nutzen, hat strategische und physikalische Gründe.

Die Hauptkunden von Isar Aerospace betreiben kleine Erdbeobachtungssatelliten, die bevorzugt über die Pole fliegen, um die Erdoberfläche lückenlos zu erfassen. Von Andøya aus kann die Rakete auf direktem Weg sicher über das offene Europäische Nordmeer in diesen polaren Orbit starten, ohne Treibstoff für aufwendige Kurskorrekturen zu verbrauchen. Zudem spart der Transport der in Ottobrunn gefertigten Bauteile per LKW und Fähre nach Norwegen wertvolle Zeit und Kosten im Vergleich zu einer Verschiffung nach Französisch-Guayana.

Für Europa bleibt der anstehende Flug der „Spectrum“ ein wichtiges Puzzleteil auf dem Weg zu einem wettbewerbsfähigen, kommerziellen Zugang zum All. Sobald die Sperrzonen vor der norwegischen Küste neu eingerichtet sind, wird sich zeigen, ob das Münchner Unternehmen diese Lücke schließen kann.

Architektur statt Strukturgröße: Aachener Chip-Start-up INCIRT sichert sich 4,8 Mio. Euro

Das Halbleiter-Start-up INCIRT hat eine Finanzierungsrunde in Höhe von 4,8 Millionen Euro abgeschlossen. Angeführt wird die Runde vom finnischen Early-Stage-VC Lifeline Ventures, während der High-Tech Gründerfonds (HTGF) – der bereits in der Seed-Runde 2022 investierte – erneut mitzieht. Das frische Kapital soll die Industrialisierung und den Markteintritt einer neuen Generation von Hochleistungs-Datenwandlern beschleunigen, die vor allem in Satelliten, 5G/6G-Infrastruktur und KI-Rechenzentren zum Einsatz kommen sollen.

Hinter dem DeepTech-Unternehmen steht ein Team mit tiefen akademischen Wurzeln. INCIRT entstand Anfang 2022 als exist-gefördertes Spin-off der RWTH Aachen. Die promovierten Elektrotechniker Dr. Oner Hanay (CEO), Dr. Erkan Bayram und Dr. Mohamed Saeed Elsayed brachten das wissenschaftliche Fundament mit, während Sebastian Waters (CCO/CFO) die kaufmännische Seite abdeckt. Technisch beraten wird das Team durch Prof. Dr. Renato Negra. Bereits im Gründungsjahr sorgten die Aachener für Aufsehen und gewannen den renommierten "Falling Walls Venture"-Award.

Intelligenz schlägt Nanometer

Der technologische Ansatz von INCIRT zielt auf ein Kernproblem der Halbleiterindustrie ab: Dem klassischen „Moore’s Law“ folgend, wurden Leistungssteigerungen in der Vergangenheit vor allem durch immer kleinere Transistoren (mittlerweile im einstelligen Nanometer-Bereich) erkauft. Dieser Weg stößt an physikalische Grenzen und lässt die Produktionskosten explodieren.

INCIRT setzt stattdessen auf eine patentierte, stark parallelisierte Systemarchitektur für seine Analog-Digital- und Digital-Analog-Wandler. Laut Unternehmensangaben ermöglichen diese eine bis zu 100-mal schnellere Datenübertragung bei signifikant geringerem Energieverbrauch. Der entscheidende strategische Vorteil: Weil die Architektur so effizient ist, können die Chips im etablierten, weitaus günstigeren 22-Nanometer-Verfahren produziert werden – und zwar direkt in Europa. Das macht das Start-up zu einem spannenden Akteur im Bestreben der EU, digitale Souveränität aufzubauen und die Abhängigkeit von asiatischen Mega-Foundries wie TSMC zu verringern.

Zwischen IP-Lizenz und Hardware-Hürden

So vielversprechend die Technologie ist, so steinig ist der Weg zur Kommerzialisierung. Der globale Markt für Datenwandler wird von etablierten US-Giganten wie Analog Devices, Texas Instruments oder Broadcom dominiert. Diese Konzerne verfügen nicht nur über Milliardenbudgets für Forschung, sondern auch über extrem tief verwurzelte Lieferbeziehungen zu den großen Netzwerkausrüstern und der Raumfahrtindustrie.

Zudem offenbart die Hardware-Entwicklung extrem lange Validierungszyklen. Bauteile, die in den Weltraum geschossen werden, müssen jahrelange Zertifizierungen durchlaufen. CEO Oner Hanay formuliert dennoch das ambitionierte Ziel, in zehn Jahren bis zu 10.000 europäische Satelliten mit INCIRT-Technologie auszurüsten.

Hier drängt sich die kritische Frage nach dem finalen Geschäftsmodell auf: Zur Seed-Runde 2022 positionierte sich INCIRT noch primär als skalierbarer Anbieter von „IP-Lösungen“ (Intellectual Property), der reine Baupläne lizenziert. In der aktuellen Kommunikation rückt nun die physische "Chipproduktion" in den Vordergrund. Sollte INCIRT als "Fabless"-Unternehmen auftreten, das Chips auf eigene Rechnung produzieren lässt, sind 4,8 Millionen Euro in der Halbleiterindustrie kaum mehr als ein Tropfen auf den heißen Stein. Allein um die Maskenkosten (Tape-outs) und das Working Capital für Massenmärkte zu finanzieren, wird mittelfristig ein Vielfaches an Kapital oder ein starker Industrie-Partner nötig sein.

Fazit

Die neue Runde verschafft INCIRT die entscheidende "Runway", um erste Kundenprojekte zu starten und die Leistungsfähigkeit der Chips im harten Praxiseinsatz zu beweisen. Gelingt es den Aachenern, die Platzhirsche bei Leistung, Kosten und Liefersicherheit zu schlagen, könnte das Spin-off ein essenzieller Baustein der europäischen Telekommunikationszukunft werden. Bis dahin bleibt es eine klassische DeepTech-Wette: Hochriskant, extrem kapitalintensiv – aber mit immensem Hebel, falls sie aufgeht.