Aktuelle Events

Start-up-Insights zum Cyber Resilience Act

Neben Konzernen wie Microsoft und Siemens ist auch das Start-up Stackable Mitglied der Expert*innengruppe zum Cyber Resilience Act (CRA). Mitgründer Lars Francke war jetzt zur ersten Sitzung bei der EU-Kommission. Hier seine Insights.

Nach intensiven Verhandlungen ist der Cyber Resilience Act (CRA) in Kraft getreten. Unternehmen haben nun bis Dezember 2027 Zeit, die Anforderungen dieser EU-Verordnung zur Stärkung der Cybersicherheit umzusetzen. Doch was bedeutet der CRA konkret? Warum war er anfangs so umstritten? Und wie sollten Unternehmen nun vorgehen?

Die europäische Gesetzgebung mag oft schwerfällig erscheinen, doch in puncto Cybersicherheit zeigt sich die EU erstaunlich entschlossen. Bereits 2019 wurde der Cybersecurity Act verabschiedet, wenig später folgte die Sicherheitsrichtlinie NIS2. Nun markiert der CRA einen weiteren Meilenstein im Schutz digitaler Infrastrukturen. In einer Zeit, in der Cyberangriffe zunehmen, ist dies ein notwendiger Schritt.

Während Europa vorangeht, zeigen sich anderswo Rückschritte: In den USA wurde das unter der Biden-Regierung geschaffene ‚Cyber Safety Review Board‘ als eine der ersten Amtshandlungen der Trump-Administration wieder aufgelöst. Umso wichtiger, dass die EU hier mit einem klaren Regelwerk voranschreitet – auch wenn der Weg dorthin nicht ohne Hürden war. Vor allem das Thema Open Source führte im Vorfeld zu hitzigen Diskussionen zwischen Politik, Wirtschaft und Verbänden.

Die Zukunft der Cybersicherheit aktiv mitgestalten

Für uns bei Stackable war Open Source von Anfang an ein zentrales Thema – nicht erst seit den Debatten um den CRA. Daher war es uns ein Anliegen, an der Ausgestaltung der Verordnung mitzuwirken. Dass wir als vergleichsweise kleines Unternehmen tatsächlich in die Expertengruppe zum CRA aufgenommen wurden, war eine Überraschung. Ich erinnere mich noch genau an den Tag im Jahr 2024, als die Bestätigungsmail eintraf: „Wir fahren nach Brüssel!“, rief ich damals dem Team zu.

Die erste Sitzung des CRA-Komitees fand nun im Februar 2025 statt. Persönlich in Brüssel anwesend zu sein und mit den Big Playern wie Microsoft, Cisco oder Siemens an einem Tisch zu sitzen, war schon beeindruckend. Direkt mit anderen Expert*innen zusammenzuarbeiten, ist eine einzigartige Gelegenheit, die Zukunft der Cybersicherheit aktiv mitzugestalten. Diese Erfahrungen haben mir wertvolle Einblicke in die Mechanismen der EU-Gesetzgebung und die Bedeutung von Open Source in diesem Kontext vermittelt. Und auch, welche Arbeit noch vor uns liegt.

Ein zentraler Diskussionspunkt während der Entwicklung des CRA war die Einbeziehung von Open-Source-Software. Ursprünglich hätte der Entwurf dazu geführt, dass Open-Source-Entwickler*innen und Stiftungen denselben Verpflichtungen ausgesetzt wären wie kommerzielle Softwareanbieter. Diese Regelung hätte potenziell das Open-Source-Ökosystem in Europa gefährdet, da viele Entwickler*innen sich gezwungen gesehen hätten, ihre Software nicht mehr auf dem europäischen Markt anzubieten.

In der finalen Version des CRA wurde eine differenzierte Lösung gefunden: Die Unterscheidung zwischen kommerzieller und nicht-kommerzieller Nutzung wurde geschärft, und mit der Einführung des Begriffs „Open Source Steward“ erhalten nicht-kommerzielle Projekte eine regulatorische Sonderstellung mit reduzierten Verpflichtungen. Dies trägt dazu bei, dass Open Source weiterhin eine tragende Rolle in der europäischen Digitalwirtschaft spielen kann. Und muss. In der Expert*innengruppe gehören Open Source und welche Pflichten die Herstellenden in der gesamten Lieferkette haben, auch weiterhin zu den Kernthemen.

Das beschäftigt die Expert*innengruppe

Es gibt noch ungelöste Probleme, denen wir uns in der Expert*innengruppe stellen – etwa die internationale Abstimmung. Während Europa mit dem CRA einen ambitionierten Weg geht, sind in anderen Teilen der Welt vergleichbare Regulierungen noch nicht auf demselben Niveau. Dies könnte dazu führen, dass europäische Unternehmen im globalen Wettbewerb benachteiligt werden, während außereuropäische Anbietende weniger strenge Sicherheitsauflagen erfüllen müssen. Eine enge Zusammenarbeit mit anderen Wirtschaftsräumen bleibt für uns in der Expert*innengruppe daher enorm wichtig.

Eine längere Diskussion gab es auch beim Thema Risikobewertung. Ich selbst hatte damit bisher nur wenige Berührungspunkte in meiner beruflichen Laufbahn. Und aus Gesprächen mit anderen Unternehmer*innen konnte ich heraushören, dass es vielen Start-ups und kleineren Unternehmen auch so geht. Welche Szenarien und Leitlinien zu berücksichtigen sind, ist vielerorts nicht klar. Manche Teilnehmenden der Expert*innengruppe sprachen sich für minimale Vorgaben aus, um das Thema nicht zu kompliziert zu gestalten. Andere sprachen sich für Anleitungen von der Kommission aus, damit Unternehmen einen Fahrplan an der Hand haben. Letztere Variante dürfte vor allem für kleine Unternehmen hilfreich sein. Doch auch jetzt sollten sich alle Markteilnehmer*innen bereits damit auseinandersetzen. Die Zeit drängt.

Berichtspflicht ab 2026, Übergangsfrist bis Dezember 2027

Unternehmen haben eine Übergangsfrist bis Dezember 2027, um sich auf die neuen regulatorischen Anforderungen einzustellen. Ab September 2026 greift sogar schon die Berichtspflicht, etwa bei Vorfällen oder Schwachstellen – viel Zeit bleibt also nicht. Vor allem, weil die Umstellung eine sorgfältige Analyse der eigenen Prozesse und Systeme erfordert. Wer bisher keine systematische Dokumentation seiner Softwareentwicklungs- und Sicherheitspraktiken vorgenommen hat, muss damit beginnen, eine lückenlose Nachweisführung zu etablieren. Es gilt, detailliert zu erfassen, welche Softwarekomponenten und Drittanbieter-Lösungen im Einsatz sind und welche Sicherheitsmaßnahmen implementiert wurden.

Ein funktionierendes Schwachstellenmanagement ist essenziell. Unternehmen müssen in der Lage sein, Bedrohungen frühzeitig zu identifizieren und angemessen darauf zu reagieren. Dazu gehört auch eine umfassende Transparenz über die gesamte Software-Lieferkette hinweg. Woher stammen genutzte Code-Komponenten? Welche potenziellen Risiken bergen sie? Nur wer diese Fragen klar beantworten kann, wird langfristig regulatorische Sicherheit gewährleisten können.

Die Umsetzung darf nicht aufgeschoben werden. Eine schrittweise Integration der neuen Vorgaben sollte sofort angegangen werden, um Nachholbedarf kurz vor der Frist zu vermeiden und Compliance-Prozesse nachhaltig zu verankern.

Ein Lackmustest für die Regulierung

Der CRA setzt einen wichtigen Meilenstein in der europäischen Cybersicherheitsstrategie. Entscheidend wird sein, ob die Umsetzung in der Praxis effizient gestaltet wird oder ob sie Unternehmen mit bürokratischen Hürden überlastet. Wer sich frühzeitig mit den neuen Anforderungen auseinandersetzt, kann einen Wettbewerbsvorteil erzielen, indem er Cybersicherheit als integralen Bestandteil seiner digitalen Strategie etabliert.

Für Open Source wurde eine tragfähige Lösung gefunden, doch das regulatorische Umfeld bleibt herausfordernd. Es ist essenziell, den Dialog zwischen Industrie, Regulierungsbehörden und der Open-Source-Community weiterzuführen, um praktikable Lösungen zu entwickeln.

Cybersicherheit ist kein statisches Ziel, sondern eine fortwährende Herausforderung – der CRA ist ein erster, notwendiger Schritt, doch seine Wirksamkeit wird von der konsequenten und durchdachten Umsetzung abhängen. Der regulatorische Rahmen steht, jetzt liegt es an der Wirtschaft und der Politik, diesen mit Augenmaß und Weitsicht mit Leben zu füllen.

Der Autor Lars Francke ist Co-Founder der 2020 von ihm und Sönke Liebau gegründeten Stackable GmbH. Das Unternehmen entwickelt eine modulare Open-Source-Datenplattform, die die gängigsten Data Apps bündelt.

Diese Artikel könnten Sie auch interessieren:

5 Mio. Euro für die „Schreibtischlosen“: Kann Elephant den Frontline-Markt wirklich digitalisieren?

Operative Teams in der Produktion, der Logistik oder im Service gelten bei der Digitalisierung oft als vernachlässigt. Das Berliner Start-up Elephant verspricht Abhilfe durch KI-gestütztes Micro-Learning und sicherte sich dafür nun 5 Millionen Euro. Doch zwischen dem PR-Versprechen und der harten Shopfloor-Realität warten ein eng besetzter Markt und die Gefahr der technologischen Austauschbarkeit.

Die aktuelle Finanzierungsrunde wird von den Corporate-Venture-Capital-Einheiten (CVC) EnBW New Ventures und Wepa angeführt. Dass ausgerechnet diese Player investieren, ist kein Zufall: Die Mutterkonzerne steuern selbst riesige operative Belegschaften. Sie dienen der Elephant Technologies GmbH somit nicht nur als Geldgeber, sondern gleichzeitig als Testlabor und Referenzkund*innen. Ergänzt wird die Runde durch namhafte Angel-Investoren aus dem Umfeld von Flix und Home24.

Das Geschäftsmodell: KI-Kurse gegen das „Wissens-Leck“

Die Gründer Maurice Zomorrodi, Niklas Dehio und Melchior Schramm riefen Elephant im Sommer 2022 ins Leben. Sie adressieren ein strukturelles Problem: Wissen wird in operativen Betrieben oft noch mündlich oder über veraltete Handbücher weitergegeben. Die Elephant-Plattform nutzt einen KI-gestützten „Coursebuilder“, um aus bestehenden Dokumenten mit wenigen Klicks interaktive Lerneinheiten für eine mobile App zu generieren. Ein KI-Assistent soll Fragen zudem kontextbezogen direkt am Arbeitsplatz beantworten. Um Sprachbarrieren in der Industrie abzubauen, bietet das System Übersetzungen in über 95 Sprachen. Dass das Modell Anklang findet, zeigt sich am Solar-Einhorn Enpal, das Elephant zur Schulung von Quereinsteigern nutzt.

Journalistisch betrachtet muss man jedoch das Preisschild hinterfragen: Der Einstieg in die Plattform beginnt bei 640 Euro monatlich für bis zu 50 Nutzer*innen („Team“) und skaliert über 1.300 Euro („Pro“) bis hin zu Enterprise-Lösungen ab 4.000 Euro im Monat. Für Mittelständler*innen ist das ein beachtlicher Kostenblock, der sich zügig durch messbar sinkende Fehlerquoten oder kürzere Onboarding-Zeiten rechtfertigen muss.

Ein Markt im Goldrausch: Wer sind die Jäger*innen?

Elephant ist längst nicht allein auf der Jagd nach der „Deskless Workforce“. Dieses enorme Segment hat in den letzten Jahren mächtige Wettbewerber auf den Plan gerufen. So hat beispielsweise der Branchen-Riese Beekeeper die Frontline-Trainingsplattform eduMe nahtlos in seine App integriert, um Mitarbeitenden Weiterbildung mit nur einem Klick zugänglich zu machen. Solche Konsolidierungen zeigen: Der Standard im operativen Weiterbildungsmarkt wird zunehmend höher.

Zwischen Innovation und Commodity

Trotz des Kapitalschubs steht das Start-up vor zwei entscheidenden Hürden. Erstens droht der technologische Kern – das Umwandeln von PDFs in Quizze mittels KI – zu einer reinen „Commodity“ zu werden. Da große Sprachmodelle (LLMs) rasant mächtiger werden, könnten generische Unternehmenstools diese Funktion bald als Standard-Feature mitliefern. Elephant muss beweisen, dass sich die Plattform unverzichtbar tief in echte Qualitätssicherungs- und Produktionsprozesse verwebt.

Zweitens bleibt der Faktor Mensch das größte Risiko. Software für den Shopfloor scheitert selten am Management, sondern oft an der fehlenden Akzeptanz der Belegschaft. Wenn die App im stressigen Arbeitsalltag nicht als spürbare Entlastung wahrgenommen wird, nützt auch die beste KI wenig.

Unser Fazit

Ein valider Ansatz unter hohem Konkurrenzdruck Elephant hat mit EnBW und Wepa die idealen Partner gefunden, um die Praxistauglichkeit in großen Strukturen unter Beweis zu stellen. Die 5 Millionen Euro geben den nötigen Runway. Dennoch ist der technologische Burggraben schmal. Um langfristig gegen internationale Schwergewichte zu bestehen, muss Elephant mehr sein als nur ein komfortabler Content-Generator. Der echte Härtetest beginnt an der Werkbank.

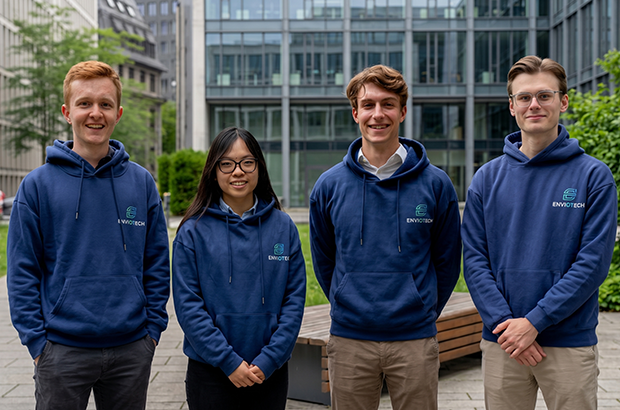

ENVIOTECH sichert sich Millionenfinanzierung für intelligente öffentliche Straßenbeleuchtung

Das Frankfurter Start-up ENVIOTECH rund um Adrian Rhaese, Linh Pham, Dustin Arnold und Peter Kletsko hat eine Pre-Seed-Runde in Höhe von einer Million Euro abgeschlossen, um öffentliche Straßenbeleuchtung intelligent nachzurüsten. Doch der Markt für kommunale Infrastruktur ist hart umkämpft und bürokratisch. Kann das junge Team die öffentlichen Verwaltungen überzeugen?

Es ist ein klassisches Gründer*innen-Narrativ: Aus einem persönlichen Schmerzpunkt entsteht eine Geschäftsidee. Im Fall von ENVIOTECH war es ein Fahrradunfall. Der beste Freund von Mitgründer Adrian Rhaese verunglückte, weil in einer deutschen Stadt die Straßenlaternen aufgrund gestiegener Stromkosten abgeschaltet worden waren. Dieser Vorfall weckte bei Rhaese das Unverständnis darüber, dass in einem wirtschaftlich starken Land ausgerechnet an der Sicherheit gespart wird – und legte den Grundstein für das Smart-City-Start-up.

Bye-bye Bankenturm: Der Sprung ins kalte Wasser

Anstatt ihren als sicher geltenden Karriereweg fortzusetzen, verließen Adrian Rhaese und Mitgründerin Linh Pham ihre Positionen als duale Studierende bei der Deutschen Bank. Sie entschieden sich bewusst für das unternehmerische Risiko, um reale Infrastrukturprobleme zu lösen.

Eine erste Bestätigung für diesen Schritt erhielt das junge Team durch die Aufnahme in das EWOR Fellowship. Daniel Dippold, Gründer und CEO von EWOR, bescheinigt dem Team den richtigen Fokus: „Unspektakuläre Infrastruktur gewinnt langfristig fast immer. Straßenbeleuchtung ist nicht glamourös, aber sie ist allgegenwärtig, unverzichtbar und aus keiner Stadt wegzudenken.“

Plug-and-Play am Lichtmast: Das 15-Minuten-Update

Die technische Lösung von ENVIOTECH setzt auf Pragmatismus: Anstatt Laternen kostenintensiv komplett auszutauschen, bietet das Unternehmen ein Retrofit-System an. Das Produkt soll sich laut Unternehmensangaben in unter 15 Minuten in bestehende Leuchten integrieren lassen.

Die nachgerüsteten Laternen kommunizieren als Mesh-Netzwerk miteinander und dimmen das Licht KI-gesteuert und bedarfsgerecht anhand von Bewegungserkennung. Das Startup verspricht dadurch Energieeinsparungen von bis zu 80 Prozent; gleichzeitig soll die öffentliche Sicherheit erhöht werden. Kommunen erhalten so die Möglichkeit, ihre Beleuchtung zentral zu steuern und in Echtzeit zu überwachen.

Um das Konzept in die Fläche zu tragen, konnte ENVIOTECH nun eine Pre-Seed-Finanzierung in Höhe von 1 Million Euro einsammeln. Angeführt wird die Runde passenderweise vom ehemaligen Co-CEO der Deutschen Bank, Jürgen Fitschen. Ergänzt wird das Konsortium durch Ex-MAN-CEO Joachim Drees, Alexander Eyhorn (Gründer von Bidirex) und Danilo Jovicic-Albrecht (Mitgründer des auf Kommunen spezialisierten Startups Vialytics). Mit dem frischen Kapital sollen Pilotprojekte forciert und das Technologieportfolio weiterentwickelt werden.

Der Endgegner heißt B2G-Markt: David gegen die Industrie-Goliaths

So einleuchtend die Technologie klingt, das Geschäftsmodell von ENVIOTECH steht vor gewaltigen Hürden. Der B2G-Markt (Business-to-Government) ist für Start-ups extrem schwierig. Kommunen, die ENVIOTECHs primäre Zielgruppe darstellen, arbeiten mit langen Budgetzyklen und streng regulierten öffentlichen Ausschreibungsverfahren. Bis ein Pilotprojekt zu einem flächendeckenden Rollout führt, vergehen oft Jahre.

Darüber hinaus agiert das Start-up nicht im luftleeren Raum. Der Smart-Lighting-Markt wird von Industriegiganten wie Signify oder Schréder dominiert, die längst eigene IoT-Lichtsteuerungssysteme anbieten. Auch andere Start-ups wie Tvilight oder Icegateway haben das Potenzial vernetzter Straßenbeleuchtung erkannt.

Der entscheidende USP von ENVIOTECH muss daher in der Geschwindigkeit und Einfachheit liegen: Gelingt die versprochene rasante Installation und können Kommunen die Lösung ohne massive Tiefbauarbeiten testen, hat das Start-up einen echten Wettbewerbsvorteil. Besonders klug ist hierbei die Auswahl der Investor*innen: Mit Drees und Jovicic-Albrecht hat das Gründerduo Köpfe an Bord geholt, die wissen, wie man komplexe Produkte an die öffentliche Hand verkauft. Schafft es ENVIOTECH, den extrem zähen Vertriebszyklus öffentlicher Verwaltungen zu knacken, könnte das Unternehmen zu einem hochrentablen Hidden Champion heranwachsen.

Gründer*in der Woche: SIRPLUS – Überlebenskampf im Food-Outlet-Markt

Während der millionenschwere Rivale Motatos aus Deutschland flieht, schreibt ein einstiger Sanierungsfall plötzlich schwarze Zahlen. Wie unser(e) Gründer*in der Woche – das Berliner Social Business SIRPLUS von Raphael Fellmer – vom gehypten Start-up zum krisenerprobten Mittelständler reifte.

Das Berliner Social Business SIRPLUS hat bewegte Jahre hinter sich. Nach einer überstandenen Insolvenz 2024 erfindet sich das ehemalige Vorzeige-Start-up um Gründer Raphael Fellmer aktuell neu – und setzt auf Community statt auf klassisches VC-Kapital. Mitten in diese Konsolidierungsphase platzt im April 2026 der Deutschland-Rückzug des Konkurrenten Motatos. Ein Lehrstück über die harten Grenzen des Skalierens und den schmerzhaften Weg vom gehypten Start-up zum krisenerprobten Mittelständler.

Paradoxon im Food-Markt: Der Sanierungsfall überlebt den Giganten

Es ist eine Nachricht, die in der hiesigen FoodTech-Szene aktuell für ein mittelschweres Beben sorgt: Der schwedische Online-Discounter Motatos zieht sich aus Deutschland zurück. Trotz rund 300.000 aktiven Kund*innen und einem beachtlichen Jahresumsatz von über 35 Millionen Euro zieht das Unternehmen Mitte April 2026 die Reißleine. Das Deutschland-Geschäft blieb hochgradig defizitär. Die Begründung: Man wolle sich auf das profitable Wachstum in den nordischen Heimatmärkten konzentrieren. Dieser Rückzug wirft ein grelles Licht auf die strukturellen Herausforderungen des deutschen Lebensmittelmarkts. Doch während der finanzstarke Konkurrent aus dem Norden kapituliert, hält ausgerechnet das Berliner Unternehmen SIRPLUS die Stellung – ein Turnaround-Case, der erst vor Kurzem selbst am Abgrund stand.

Warum überlebt SIRPLUS dort, wo ein millionenschwerer Riese aufgibt? Gründer Raphael Fellmer macht sich keine Illusionen über das Marktumfeld. „Wir haben in Deutschland wohl einen der härtesten umkämpften Lebensmittelmärkte in der EU“, analysiert er die Lage. Dass nach dem US-Giganten Walmart nun mit Motatos der nächste Konzern den Rückzug antrete, sei bezeichnend. Die eigene Überlebensstrategie liege in den Lehren der bitteren Vergangenheit. „Wir haben bei SIRPLUS 2.0 einen so radikalen Pivot hingelegt, wie ich es nicht für möglich gehalten hätte“, betont der Gründer. Das Erfolgsrezept liege heute nicht mehr in der reinen Größe, sondern in extremer Agilität und einem strikten Fokus auf organisches Wachstum. Die Rechnung scheint aufzugehen: Auch wenn die Berliner rund 20-mal weniger Umsatz machen als der scheidende Konkurrent Motatos, schreiben sie laut Fellmer bereits schwarze Zahlen. Für 2026 kündigt er erstmals seit der Gründung mehr Einnahmen als Ausgaben an.

„Das entlastet mich persönlich sehr, weil ich seit Jahren im Dauerfunding-Modus bin.“

Raphael Fellmer über die ersten schwarzen Zahlen seit der Gründung 2017

„Wir sind nicht per Du“: Wenn Purpose auf Realität prallt

Die Geschichte von SIRPLUS ist untrennbar mit seinem prominenten Gründer verbunden. Der Klimaaktivist erlangte Bekanntheit, weil er aus Protest gegen die Wegwerfgesellschaft fünfeinhalb Jahre lang komplett ohne Geld lebte und sich durch „Containern“ ernährte. Nach dem Aufbau der Foodsharing-Initiative folgte 2017 gemeinsam mit Martin Schott die Gründung von SIRPLUS. Das Kern-Geschäftsmodell: Das Unternehmen rettet bei Produzent*innen und Großhändler*innen überschüssige Ware – etwa wegen nahendem Mindesthaltbarkeitsdatum (MHD), Überproduktionen oder Verpackungsfehlern – und verkauft diese D2C (Direct-to-Consumer) über den eigenen Online-Shop mit Rabatt an Endkund*innen.

Damals griff das Team mit diesem Konzept nach den Sternen des klassischen Start-up-Wachstums. Doch der Spagat zwischen Weltverbesserung und knallhart skalierbarem E-Commerce erwies sich als tückisch. Das zeigte sich eindrücklich im September 2019 bei einem denkwürdigen Auftritt in der TV-Show Die Höhle der Löwen. Fellmer und Schott forderten 700.000 Euro für 6 Prozent der Anteile – was einer überaus ambitionierten Firmenbewertung von fast 11,7 Millionen Euro entsprach.

Die Kombination aus Social-Impact-Rhetorik und massiver kapitalistischer Bewertung sorgte für einen beispiellosen Eklat. Investor Georg Kofler warf dem Duo „moralisierendes Schöngerede“ vor. Als die Gründer sich rechtfertigen wollten und Kofler dabei duzten, unterbrach dieser scharf mit einem Satz, der in die deutsche TV-Geschichte einging: „Wir sind nicht per Du. Unter Multimillionären ist man eine Weile per Sie.“ Das Team verließ das Studio ohne Deal. Die Investoren hatten den wunden Punkt getroffen: Ein gesellschaftliches Problem moralisch aufzuladen, heilt keine schwachen Unit Economics.

Rückblickend gibt sich Fellmer geläutert, verhehlt aber auch seine damalige Verletztheit nicht. Die Einladung zur Show habe man primär angenommen, um Reichweite für das Thema Lebensmittelverschwendung zu generieren. „Dass wir so stark kritisiert und vor allem auch persönlich angegriffen würden, hätte ich mir nicht vorstellen können“, gibt er unumwunden zu. Die völlig überzogene Firmenbewertung rechnet er heute der eigenen Naivität an: „Wir kannten uns nicht aus und waren glücklich darüber – ohne zu verstehen, dass eine zu hohe Bewertung auch hinderlich sein kann.“

Der harte Cut: Vom 90-Köpfe-Team zum Sanierungsfall

Die Kritik der Löwen sollte sich in gewisser Weise als prophetisch erweisen. Das Geschäftsmodell erfordert es, schwere, niedrigpreisige Güter aufwendig zu lagern, zu kommissionieren und per Paketdienst zu verschicken. Die Logistikkosten fraßen die Margen auf. Als Ende 2023 im ohnehin schwierigen Marktumfeld eine rettende Finanzierungsrunde platzte, musste SIRPLUS im Januar 2024 Insolvenz anmelden. Und das, obwohl das Team von ehemals rund 90 auf unter 30 Mitarbeitende Monate vor der Pleite radikal eingedampft wurde. Die verlustreichen stationären „Rettermärkte“ gehörten schon zwei Jahre zuvor der Vergangenheit an. Im Mai 2024 gelang zwar die Rettung durch drei Viertel der Bestandsinvestor*innen, doch der Preis war hoch: Aus dem einstigen Hyper-Wachstums-Narrativ wurde ein harter Überlebenskampf. SIRPLUS wurde zeitweise vom gehypten Start-up zum Sanierungsfall.

„Es war sehr hart, nach sieben Jahren Kampf anzuerkennen, dass wir es einfach nicht geschafft haben, wirtschaftlich zu werden.“

Raphael Fellmer über den Tiefpunkt vor dem Neustart

Der personelle Aderlass ging an die Substanz. Zwischenzeitlich kämpfte der Gründer praktisch allein, mit seinem Bruder als einzigem Mitarbeiter. Dennoch sei sein Wille ungebrochen gewesen. Den operativen Neustart nach der Pleite diktierte der Rotstift: „Leane Struktur ohne Obst und Gemüse, keine bezahlte Werbung, sondern organisches Wachstum, kein Büro, sondern Remote-Only“, summiert Fellmer die harten Schnitte. Statt teurer Bezahldeals stütze man sich heute auf langfristige Partnerschaften.

Der radikale Pivot: Community statt teurer Klicks

Aktuell ist SIRPLUS Teil der neuen YouTube-Show The Green Deal, ein Format, das gezielt die Abkehr vom rein kapitalgetriebenen Skalieren propagiert. Der neue Hebel für SIRPLUS: Reichweite, Community-Building und Creator-Beteiligungen. Die betriebswirtschaftliche Logik dahinter ist zwingend: Wenn hohe Customer Acquisition Costs (CAC) im klassischen Performance-Marketing das ohnehin margenschwache Modell ruinieren, muss die Kundenakquise organisch erfolgen. Durch die enge Bindung an Influencer und eine wertegetriebene Community sollen treue Käufer*innenschichten aufgebaut werden.

Dass dieses Konzept mehr als nur eine Notlösung für fehlendes VC-Geld ist, belegen harte Zahlen. Fellmer beziffert die aktuellen Customer Acquisition Costs stolz auf „unter 5 Euro“. Dieser Wert sei sieben- bis zehnmal besser als noch zu Zeiten von SIRPLUS 1.0. Auf klassische Bezahlkooperationen verzichtet das Start-up mittlerweile völlig; man vergütet rein über Umsatzbeteiligungen oder gespendete Schulmahlzeiten. „Wir suchen weiter nach authentischen Partnerschaften mit Menschen mit Reichweite, die sich für eine Welt einsetzen wollen, in der alle genügend zu essen haben“, skizziert Fellmer sein Anforderungsprofil an Creator. Die Strategie trägt Früchte: Von Q1 2025 auf Q1 2026 verzeichnete das Unternehmen laut Gründer ein Wachstum von 100 Prozent.

Die SIRPLUS-Formel: Drei harte Lektionen für Social Start-ups

Warum widmen wir uns bei StartingUp einem neunjährigen Unternehmen, das streng genommen längst kein Start-up mehr ist? Weil junge Gründer*innen aus exakt dieser Transformation unbezahlbare Lehren für die eigene Frühphase ziehen können:

- Purpose ersetzt keine Unit Economics: Der Fall SIRPLUS demonstriert schonungslos, dass selbst die stärkste gesellschaftliche Mission eine fehlerhafte betriebswirtschaftliche Basis (hohe Logistikkosten bei niedrigen Warenkörben) nicht dauerhaft kompensieren kann. Wer heute ein Social Start-up gründet, muss seine Margen noch rigoroser verteidigen als traditionelle E-Commerce-Modelle.

- Die Grenzen des VC-Modells erkennen: Nicht jedes Geschäftsmodell eignet sich für Venture Capital. Die Entwicklung von SIRPLUS und der aktuelle Motatos-Exit zeigen, dass der Food-Outlet-Markt extrem schwer zu skalieren ist. Junge Start-ups lernen hier, alternative Wachstumswege frühzeitig in Betracht zu ziehen, bevor sie sich in eine gefährliche VC-Abhängigkeit begeben.

- Resilienz als Kernkompetenz: Dass Raphael Fellmer das Tal der Tränen durchschritten hat und sich dem Markt nach einer Insolvenz mit angepasstem Modell neu stellt, ist ein Meisterkurs in Pivotierung und unternehmerischer Widerstandskraft.

Die Konkurrenzsituation hat sich durch den Motatos-Exit nun paradoxerweise entspannt. Ob die Gleichung „Reichweite statt Performance-Marketing“ am Ende aufgeht, wird eine der spannendsten Case Studies der aktuellen Wirtschaftsszene – und ein wertvoller Blueprint für die Start-ups von morgen.

Fellmer selbst zeigt sich für die Zukunft demütig, aber siegessicher. Auf dem Weg zur Profitabilität habe man zwar fast 10 Millionen Euro an Funding benötigt und schmerzhaftes Lehrgeld gezahlt, doch „das Dranbleiben, Neudenken und nicht Aufgeben hat sich gelohnt“. Für 2026 verspricht der Gründer erstmals ein nachhaltig profitables Gesamtjahr. Neben der rein wirtschaftlichen Stabilität hat der passionierte Kämpfer gegen Food Waste inzwischen aber auch einen „ganz profanen“ Meilenstein im Visier: „Für mich persönlich ist dieses Jahr ein echter mehrwöchiger Urlaub nach 14 Jahren des Fast-Durch-Arbeitens ein wichtiges Ziel.“

Cyber-Souveränität als Geschäftsmodell: QuoIntelligence sichert sich 7,3 Mio. Euro für den europäischen Markt

Regulierung als Wachstumstreiber: Das Frankfurter Cyber-Security-Start-up QuoIntelligence sammelt in seiner Series-A-Finanzierungsrunde 7,3 Millionen Euro ein. Das Versprechen: Hochwertige, fertig analysierte Cyber-Bedrohungsdaten speziell für den europäischen Mittelstand. Doch wie skalierbar ist der Spagat zwischen KI-Automatisierung und menschlicher Analyse, wenn man gegen etablierte US-Giganten antritt?

Der Weg von QuoIntelligence ist eng mit der Biografie seines Gründers Marco Riccardi verknüpft. Riccardi verbrachte sieben Jahre tief im IT-Sicherheitsapparat des Frankfurter Finanzsektors: Von 2013 bis 2015 war er als IT-Security-Berater für die Europäische Zentralbank (EZB) tätig, gefolgt von zwei Jahren als Threat Intelligence Analyst bei der Deutschen Bank. Vor der Gründung von QuoIntelligence Anfang 2020 leitete er zudem die Intelligence Operations beim Frankfurter Unternehmen QuoScient.

Heute führt Riccardi das Start-up mit einem europäisch aufgestellten Management-Team, dem unter anderem David Brown (UK), Antonio Arias Lopez (Deutschland), Odín Rodríguez Lago (Spanien) und Marina Gómez Lara (Spanien) angehören.

„Finished Intelligence“ statt roher Daten-Feeds

QuoIntelligence positioniert sich als Anbieter für „Unified Risk Intelligence“. Das Kernproblem vieler Unternehmen: Der Aufbau eines eigenen Cyber-Intelligence-Teams erfordert oft sechsstellige Investitionen allein für Fachpersonal. QuoIntelligence verspricht hier Abhilfe durch „Finished Threat Intelligence“ – fertig analysierte und kontextualisierte Bedrohungsinformationen, die innerhalb weniger Stunden einsatzbereit sind, ohne dass der Kunde ein eigenes internes Expertenteam benötigt.

Technologisch stützt sich das Unternehmen dabei auf zwei Säulen:

- Mercury: Die hauseigene Plattform aggregiert Erkenntnisse aus über 1.000 Quellen und nutzt eine kuratierte Wissensbasis von über 17.000 geprüften Intelligence-Tickets.

- KARLA: Ein konversationeller KI-Analyst soll diese komplexen Informationen für alle Unternehmensebenen – vom Vorstand bis zum Sicherheitsanalysten – zugänglich machen.

Das Modell stößt auf eine beachtliche Marktresonanz: Für das Jahr 2025 meldet das Startup keinen einzigen Kundenabgang (Zero Client Churn). Zudem hat sich der Customer Lifetime Value seit 2023 beinahe versechsfacht. Ein weiterer Vertrauensbeweis ist die Rolle als offizieller ENISA-Anbieter mit einem Vierjahresvertrag über 1,4 Millionen Euro seit Februar 2025.

Der Wachstumsmotor: NIS2, DORA und Daten-Souveränität

Die aktuelle Finanzierungsrunde wird von Elevator Ventures (Raiffeisen Bank International) angeführt und von der BMH Beteiligungs-Managementgesellschaft Hessen co-geführt. Beteiligt sind zudem eCAPITAL und Mercurius Private Equity. Dass hier vor allem Kapital mit starken Wurzeln im Finanzsektor fließt, ist strategisch logisch.

Der entscheidende Markttreiber sind die EU-Richtlinien NIS2 und DORA. Allein NIS2 erfasst europaweit über 160.000 Organisationen – davon über 30.000 in Deutschland – und führt zur persönlichen Haftung der Geschäftsführung bei Versäumnissen. Gleichzeitig fordern europäische Beschaffungsrahmen zunehmend, dass sensible Daten innerhalb der EU verbleiben. Hier zieht QuoIntelligence seinen entscheidenden Burggraben:

- Das Unternehmen ist nach deutschem Recht gegründet.

- Sämtliche Intelligence-Daten werden auf deutschem Boden unter EU-Recht gespeichert.

Die Herausforderungen

Trotz der strategisch klugen Positionierung gibt es Hürden:

- Skalierbarkeit: Das Modell setzt auf einen „Analyst-first“-Ansatz, bei dem Experten jede Information prüfen. Bei massivem Wachstum durch neue Vertriebskanäle muss die KI KARLA beweisen, dass sie diese Expert*innen effizient entlasten kann.

- Globale Konkurrenz: US-Schwergewichte wie CrowdStrike oder Mandiant verfügen über weit größere globale Daten-Netzwerke. QuoIntelligence setzt hier voll auf den Trumpf der „europäischen Souveränität“, um sich abzugrenzen.

- Mittelstands-Trägheit: Ob der Mittelstand über die reine Compliance-Erfüllung hinaus tatsächlich in tiefgehende Risiko-Intelligence investiert, wird das langfristige Wachstumstempo bestimmen.

Unser Fazit

QuoIntelligence zeigt sehr anschaulich, wie man Regulierung (NIS2/DORA) als stärksten Vertriebskanal nutzt. Die Wahl der Investor*innen aus dem Finanzsektor sichert den Zugang zur Kernzielgruppe. Mit der klaren Kante beim Datenschutz („Made in Germany“) besetzt das Start-up eine Nische, die für regulierte Unternehmen in Europa zur Pflicht wird. Gelingt der Spagat zwischen menschlicher Expertise und technischer Skalierung, könnte Frankfurt hier einen dauerhaften Champion der europäischen Cybersicherheit hervorbringen.

Gründer*in der Woche: Vjus.AI – Vom SEO zum GEO

Wie das 2026 von Wolfe Diener gegründete Start-up Vjus.AI den Kampf um die KI-Sichtbarkeit gewinnen will.

Die Ära der klassischen Suchmaschinenoptimierung (SEO) bekommt ernstzunehmende Konkurrenz. Wenn Nutzer*innen heute nach Produkten oder Dienstleistungen suchen, tippen sie ihre Fragen zunehmend in Dialogfenster von Sprachmodellen statt in traditionelle Suchschlitze. Genau an dieser Schnittstelle positioniert sich das neu gestartete Münchner Start-up Vjus.AI. Doch kann eine Software wirklich die „Black Box“ der generativen KI entschlüsseln – und wie nachhaltig ist das Geschäftsmodell?

Hinter der am 1. April 2026 offiziell gelaunchten Plattform steht die AtWize Business Services GmbH mit Sitz in München. Kopf des Unternehmens ist Gründer Wolfe W. Diener, der zuvor bereits in leitenden Positionen als Geschäftsführer und im Vorstand großer Softwarehäuser aktiv war. Mit dem Start von Vjus.AI vollzieht das Unternehmen nun eine strategische Erweiterung in den stark wachsenden Bereich der Answer Engine Optimization (AEO) und Generative Engine Optimization (GEO).

Vom Humankapital zur KI-Sichtbarkeit

Die Historie des Unternehmens ist dabei von einem interessanten Strategiewechsel geprägt. Ursprünglich startete AtWize 2023 mit einem Fokus auf KI-Lösungen gegen den Fachkräftemangel. Diener erklärt die Hintergründe: „Parallel hatte ich schon eine Weile an der Idee arbeitete, Unternehmen zu ermöglichen, ihre in den Ruhestand ausscheidenden Mitarbeiter strukturierter zu managen, um sie bei Bedarf für Projekte oder übergangsweise anzusprechen. Es liegt so viel Humankapital und Erfahrung brach.“ In der aktuellen wirtschaftlichen Phase sei dies jedoch kein Top-Thema gewesen, weshalb man sich zunächst auf die Software-Entwicklung für Dritte konzentriert habe.

Der eigentliche „Aha-Moment“ kam durch die tägliche Arbeit. „Im letzten Jahr haben wir dann immer mehr auch KI-Tools zur Entwicklung eingesetzt und dabei den Bedarf, sogar die Notwendigkeit erkannt, die Sichtbarkeit in KI-Modellen zu messen und zu verbessern“, so Diener. Die Dringlichkeit begründet er mit dem veränderten Nutzer*innenverhalten: „KI-Modelle geben begründete Empfehlungen zur gestellten Frage. Da sucht man nicht weiter, sondern nimmt das Ergebnis wie es ist. Wer da nicht enthalten ist, ist unsichtbar.“

Nutzer*innensimulation: Die reale Perspektive

Vjus.AI setzt auf die Simulation realer Suchanfragen. Während klassische SEO-Tools oft auf APIs zugreifen, misst diese Plattform, wie Marken in Antworten von ChatGPT, Gemini, Grok oder Perplexity tatsächlich erscheinen. Auf die Frage nach der technischen Umsetzung und der Nicht-Deterministik der KI-Modelle antwortet Diener detailliert: „Wenn Sie Ihre Sichtbarkeit bei KI-Suchen wissen wollen, dann sollte diese ja so gemessen werden, wie sie ein normaler Nutzer, der einem KI-Modell eine Frage stellt, einen Prompt eingibt, auch sieht.“ Man müsse also zunächst Prompts definieren, bei denen man gefunden werden wolle – etwa als Münchner Zahnarzt bei der Frage nach dem besten Zahnarzt vor Ort.

„Wir analysieren die Ergebnisse, die von den KI-Modelle auf die Prompts hin geliefert werden“, erklärt Diener weiter. Dabei werden Kennzahlen wie Sichtbarkeit, Ranking und Sentiments (neutrale, positive oder negative Notation) erhoben. Den Vorwurf einer verzerrenden technischen Schicht weist er zurück: „Wir sind insofern keine Zwischenschicht, sondern werten die Daten aus, die viele User auch sehen würden. Die Nicht-Deterministik führt dabei zwar zu kleinen Schwankungen, aber es entsteht insgesamt ja ein Bild über die Zeit.“

Marktchancen und der „Unfair Advantage“

Das Interesse am Markt scheint groß zu sein; bereits vor dem offiziellen Launch konnten erste Kund*innen gewonnen werden. Finanziell steht das Start-up auf eigenen Beinen: „Wir finanzieren uns komplett aus eigenen Mitteln. Und da wir schon Kunden im Entwicklungsbereich haben, konnten wir Vjus.AI früh anwenden und testen“, betont der Gründer. Mit Investor*innen habe man noch nicht gesprochen: „Jetzt erst mal machen, dann reden wir.“

Um sich gegen die großen SEO-Platzhirsche zu behaupten, setzt Diener auf vier spezifische technische Vorteile. Erstens setze man auf eine natürliche Simulation: „Unsere Art des Promptens simuliert wirklich natürliche User. Andere machen das nicht.“ Zweitens komme eine eigene Scraping-Technologie zum Einsatz. Diese erlaube eine besonders detaillierte Analyse der Ergebnisse, auch der „Nebengeräusche“ wie etwa Quellenangaben. Als dritten Punkt nennt der Gründer das analytische Prompting: Vjus.AI unterstützt nicht nur beim Erstellen von Prompts, sondern analysiert auch, wie passend diese für die Sichtbarkeitsmessung sind. Viertens biete das Improver-Modul ein Analyse-Tool, das über die Daten hinweg ermittelt, „was die Haupthebel für das Unternehmen oder die Marke ist, um die Sichtbarkeit bei KI-Suchen zu erhöhen“.

GEO als neues Standard-Tool?

Für die Zukunft sieht Diener eine klare Entwicklung. Zwar werde es in zwei Jahren wahrscheinlich immer noch die klassische Google-Suche geben, doch der Übergang sei bereits fließend, da Google zunehmend KI-Ergebnisse mitliefere. „Die Suche mit KI-Modellen wird aber die gewohnte Praxis werden“, ist sich Diener sicher.

Seine Prognose für die Branche ist deutlich: „Insofern wird SEO eher übergehen in ein GEO. Ein SEO ohne Beachtung der Optimierungen für KI-Modelle macht aus meiner Sicht aber heute schon keinen Sinn mehr.“ Das Ziel für Vjus.AI ist dabei klar gesteckt. Die größte Hürde sei es, für die Nutzer*innen den besten Mehrwert zu generieren: „Darauf liegt unser Fokus und deshalb rennen wir, so schnell wir können.“

Energie-Betriebssystem fürs Mehrfamilienhaus: Berliner Start-up VREY sichert sich 3,3 Millionen Euro Seed-Kapital

Das Climate-Tech-Start-up VREY sammelt eine Millionenfinanzierung ein, um sich als zentrales „EnergyOS“ für Vermieter*innen zu etablieren. Doch der Markt ist umkämpft und hält operative Tücken bereit.

VREY (rechtlich firmierend unter RE Joule GmbH ) hat den Abschluss einer Seed-Finanzierungsrunde in Höhe von 3,3 Millionen Euro bekannt gegeben. Angeführt wird die Runde von Rubio Impact Ventures. Als weitere Investor*innen steigen der High-Tech Gründerfonds (HTGF) sowie der Impact-Investor Kopa Ventures ein. Das frische Kapital soll in die Skalierung des aktuell rund 20-köpfigen Teams sowie in die Weiterentwicklung der eigenen Software-Plattform fließen.

Warum PV auf Mietshäusern bisher oft scheiterte

Solaranlagen auf Einfamilienhäusern sind längst ein Erfolgsmodell, doch auf Mehrfamilienhäusern galten sie lange als operativ komplex und wirtschaftlich wenig attraktiv. Der Hauptgrund: Vermieter*innen, die ihren Mieter*innen Strom vom eigenen Dach anbieten wollten, fielen beim klassischen Mieterstrom-Modell schnell in die Pflichten eines vollwertigen Energieversorgers. Sie mussten unter anderem eine Vollversorgung garantieren – also auch dann Reststrom einkaufen und liefern, wenn die Sonne nicht schien. Komplexe Abrechnungsprozesse und teure Messtechnik schreckten zusätzlich ab.

Mit der Einführung der „Gemeinschaftlichen Gebäudeversorgung“ (GGV) entfällt ein Großteil dieser Hürden, insbesondere die Notwendigkeit für Eigentümer*innen, selbst als Energieversorger*innen aufzutreten.

VREY als „EnergyOS“

Genau auf diese regulatorische Neuerung setzt VREY. Das Start-up kombiniert eine automatisierte Abrechnungssoftware mit der Zulassung als zertifizierter Messstellenbetreiber. VREY positioniert sich damit als eine Art Betriebssystem („EnergyOS“) für die Messung, Abrechnung und Steuerung von Energieflüssen im Mehrfamilienhaus.

Die Wertschöpfung ist in der Theorie für alle Parteien lukrativ:

- Vermieter*in: Eine typische 30-kWp-Anlage auf einem Zehn-Parteien-Haus kann laut VREY rund 5.500 Euro an zusätzlichen jährlichen Einnahmen generieren.

- Mieter*in: Bewohner*innen können ihren Strom bis zu 20 Prozent günstiger beziehen, was laut Unternehmensangaben jährlichen Einsparungen von etwa 120 bis 250 Euro entspricht.

Hohes Tempo seit Gründung

Gegründet wurde VREY im Jahr 2024 von Julius Pahmeier und Cedric Jaeger. Das Tempo des Gründerduos ist beachtlich: Laut Unternehmensangaben hat VREY bereits eine dreistellige Anzahl von Projekten in allen 16 Bundesländern umgesetzt. Die Kundschaft reicht von privaten Vermietern bis hin zu großen Immobilienunternehmen und Wohnungsbaugenossenschaften.

Flaschenhälse und Konkurrenzkampf

Der adressierbare Markt für VREY ist mit über 20 Millionen potenziellen Wohneinheiten in Deutschland enorm. Doch das Start-up bewegt sich keinesfalls im luftleeren Raum.

Der Wettbewerb: Die Marktchancen der GGV haben auch andere Player erkannt. Etabliertere Lösungsanbieter wie Einhundert Energie, Metergrid, Pionierkraft oder das zu Enviria gehörende prosumergy adressieren den Markt für dezentrale Energieversorgung teils seit Jahren mit eigenen Hard- oder Softwarelösungen. VREY muss in der Praxis beweisen, dass die eigene Plattform-Architektur der Konkurrenz langfristig überlegen ist.

Operative Hürden: Obwohl die gesetzlichen Rahmenbedingungen verbessert wurden, ist die Umsetzung oft steinig. Branchenverbände wie die Deutsche Gesellschaft für Sonnenenergie (DGS) kritisieren, dass die Umsetzung der GGV in Deutschland derzeit vielerorts an strukturellen Blockaden der klassischen, grundzuständigen Messstellenbetreiber scheitert. Es kommt zu Verzögerungen beim zwingend notwendigen Einbau intelligenter Messsysteme (Smart Meter).

VREY umgeht diesen Flaschenhals clever, indem das Unternehmen selbst als zertifizierter Messstellenbetreiber agiert und sich so autark von lokalen Netzbetreiber*innen macht. Dennoch bleibt eine zweite operative Hürde bestehen: Die Installation der Anlagen. Hier verlässt sich VREY auf lokale, frei wählbare Installationsbetriebe. Das Wachstum des Start-ups korreliert somit unweigerlich mit den Kapazitäten und dem anhaltenden Fachkräftemangel im deutschen Handwerk.

Fazit

VREY zeigt, wie Start-ups durch neue regulatorische Rahmenbedingungen Märkte erschließen können, die vorher als unprofitabel galten. Die Kombination aus Software-Abrechnung und der Lizenz als eigener Messstellenbetreiber ist ein starker USP, um bürokratische Trägheit zu umschiffen. Mit der soliden Seed-Finanzierung im Rücken hat das Team nun den nötigen Spielraum, um im Kampf um die deutschen Mietshaus-Dächer eine entscheidende Rolle einzunehmen – sofern die Koordination mit dem Handwerk reibungslos skaliert.

BRYCK Startup Alliance: Vom Kohlenpott zum Code-Pott

Das Bundesministerium für Wirtschaft und Energie (BMWE) hat mit den exist Startup Factories ein hochambitioniertes Förderprogramm aufgesetzt. Das Ziel: Wissenschaftliche Erkenntnisse sollen schneller und skalierbarer in die Wirtschaft überführt werden. Eines der Leuchtturmprojekte entsteht derzeit im Ruhrgebiet. Wir werfen einen Blick auf den Status quo der BRYCK Startup Alliance, die Macher*innen im Hintergrund und die Frage, was das Konstrukt Gründenden in der Praxis wirklich bringt.

Deutschland habe ein Transferproblem, so die Analyse der Initiatoren. Während die heimischen Universitäten in der Grundlagenforschung weltweit Spitzengeschwindigkeiten fahren, gerate der Motor ins Stottern, sobald es darum gehe, aus diesen Erkenntnissen marktreife Unternehmen zu formen. Genau hier setzen die geförderten exist Startup Factories an. Sie haben den Auftrag, die Quantität und Qualität wissensbasierter Ausgründungen signifikant zu steigern.

Das Silicon Valley der Schwerindustrie?

Geführt wird die BRYCK Startup Alliance, die 2025 als einer der Sieger des exist-Wettbewerbs gekürt wurde, von einem fünfköpfigen Führungsteam um Geschäftsführer Philipp Herrmann. Herrmann, selbst Seriengründer und Investor, soll die Brücke zwischen akademischer Forschung und traditionellen Corporate-Strukturen schlagen. Das Ziel ist gewaltig: Das Ruhrgebiet soll sich zur führenden Modellregion für industrielle Erneuerung in Europa wandeln.

Warum aber ausgerechnet DeepTech und nicht etwa digitale B2B-Software, wo die Einstiegshürden niedriger wären? Herrmann stellt klar: „Weil wir hier nicht die x-te Region bauen sollten, die versucht, ein kleines Silicon Valley zu spielen.“ Das Ruhrgebiet habe andere Stärken, wie eine enorme Dichte an Hochschulen, Industrie und konkreten Anwendungsfeldern. Für ihn liegt die Zukunft Europas nicht in reinen Softwaremodellen, sondern in Feldern wie Energie, Wasserstoff oder industrieller Effizienz. „DeepTech hat für diese Region einen anderen Hebel“, betont er. Wenn hier etwas funktioniere, habe es echte Wirkung auf industrielle Prozesse und neue Wertschöpfung. Sein Fazit für die Region: „Nicht den schnellsten Hype, sondern den nachhaltigsten Umbau.“

Eine beispiellose Allianz – und potenzielle Corporate-Falle?

Das Fundament der Allianz ist massiv: Die Universitätsallianz Ruhr kooperiert mit der RAG-Stiftung und dem Initiativkreis Ruhr, einem Bündnis aus über 70 Konzernen wie E.ON oder RWE. Für Start-ups klinge das theoretisch nach einem Sechser im Lotto. In der Praxis jedoch drohen agile Gründer*innen oft in den bürokratischen Mühlen der Großkonzerne zu ersticken.

Herrmann räumt unumwunden ein: „Die Gefahr besteht absolut.“ Große Unternehmen seien nicht per se schnell, und Konzernprozesse könnten für junge Teams zermürbend sein. Die Allianz setze daher nicht auf bloßes Networking, sondern auf harte Vorsortierung. „Unser Job ist, viel stärker vorzusortieren: Wo gibt es ein echtes Problem? Wo gibt es auf Unternehmensseite jemanden, der das Thema wirklich treiben will?“ Ein echter „Fast Track“ sei am Ende immer ein gut vorbereiteter Prozess. Zwar werde dadurch nicht jede Reibung verschwinden, aber man könne die Wahrscheinlichkeit für erfolgreiche Pilotprojekte massiv erhöhen.

Status quo: Die Realitätsprüfung

Seit dem Start ist viel passiert: Weit über 130 Start-ups haben die Programme bereits durchlaufen. Zudem wurde mit „GF BRYCK Ventures“ ein 10-Millionen-Euro-Fonds für Frühphasen-Investments etabliert. Doch Herrmann gibt zu, dass zwischen Masterplan und Realität oft Welten liegen.

Besonders die Kluft zwischen Universität, Start-up und Konzern habe ihn in der täglichen Arbeit gefordert. Man habe gelernt, dass ein gutes Ökosystem neben einem „Nordstern“ vor allem „sehr viel operative Kleinarbeit an all den zu verändernden Schnittstellen“ benötige. DeepTech sei eben kein Sprint. „Das Ruhrgebiet verändert man auch nicht mit einer großen Überschrift“, so Herrmann. Vielmehr verändere man es Schritt für Schritt durch funktionierende Beispiele.

Der harte Weg aus dem Labor

Zwei der größten „Start-up-Killer“ bei Uni-Ausgründungen sind ungeklärte Patentrechte (IP) und einseitige Teams aus Forschenden ohne Vertriebserfahrung. Herrmann fordert hier bei den IP-Prozessen vor allem Geschwindigkeit und Verlässlichkeit. „Nichts ist schädlicher als Monate der Unklarheit.“

Gleichzeitig legt er den Fokus auf das Matching der Teams. Während die „Nerds“ aus dem Labor für die Technologie unverzichtbar seien, entstehe ein Unternehmen erst, wenn technologische Exzellenz und unternehmerische Kompetenz zusammenkommen. Er plädiert für ein neues Selbstverständnis: „Ich finde auch, wir müssen weg von diesem alten Denken, dass Forschung und Unternehmertum zwei getrennte Welten seien. Im Idealfall ist Unternehmertum der Weg, wie aus guter Forschung Wirkung wird.“

Was kostet die Förderung?

Mit dem neuen Fonds investiert die Allianz bis zu 300.000 Euro in der ganz frühen Phase. Pauschale Deal-Terms gebe es dabei bewusst nicht, da die Situationen der Teams zu unterschiedlich seien. Herrmann betont jedoch ein wichtiges Prinzip: „Frühphasenfinanzierung darf Gründer nicht klein, sondern muss sie handlungsfähig machen.“

Da 300.000 Euro bei DeepTech-Hardware oft nur ein Anfang sind, müsse man das „Valley of Death“ durch breitere Kapitalzugänge schließen. Er sieht hier eine große Aufgabe für ganz Europa: „Wir brauchen mehr geduldiges Kapital und bessere Anschlussfinanzierung für wissenschaftsbasierte Unternehmen.“ Ziel sei es, die Teams so aufzustellen, dass sie auch die nächste und übernächste Runde erreichen können.

Ausblick: Eine Milliarde fürs Ruhrgebiet

Bis 2030 sind die Ziele messbar: 1.000 wissenschaftsbasierte Ausgründungen und eine Milliarde Euro mobilisiertes Risikokapital. Ob das Projekt ein Erfolg wird, mache Herrmann an substanziellen Ergebnissen fest.

„Im Kern werden wir nur dann wirklich Strahl- und Magnetkraft auf europäischer Ebene entwickeln, wenn aus unseren Startups groß skalierte Unternehmen entstehen – wirkliche Unicorns, die Industrien verändern“, kontert er. Man müsse beweisen, dass hier Firmen entstehen, die industrielle Probleme auf Weltklasseniveau lösen. Sein Wunsch für die nächsten vier Jahre: „Dass das kein spannendes Einzelprojekt mehr ist, sondern ein funktionierendes System mit echter Zugkraft.“ Wenn die ersten Teams aus diesem System zu echten Erfolgsgeschichten werden, sei das der stärkste Beleg für den Erfolg.

Factsheet: BRYCK Startup Alliance auf einen Blick

- Offizieller Name: BRYCK Startup Alliance

- Fokus: DeepTech, B2B, industrielle Transformation

- Status: Prämierte exist Startup Factory des BMWE (Entscheidung am 10. Juli 2025)

- Geschäftsführung: Philipp Herrmann, Dr. Christian Lüdtke, Philippa Köhnk, Ersin Üstün, Maximilian Weil-Schimanski

- Wissenschaftliches Rückgrat: Universitätsallianz Ruhr (Bochum, Dortmund, Duisburg-Essen)

- Wirtschaftliches Netzwerk: Initiativkreis Ruhr (über 70 Top-Unternehmen) & RAG-Stiftung

- Finanzierung: GF BRYCK Ventures (10 Mio. Euro Fonds, Tickets bis zu 300.000 Euro)

- Ziele bis 2030: 1.000 Ausgründungen, 200 skalierende DeepTech-Start-ups, 1 Mrd. Euro mobilisiertes Kapital

- Website: bryckstartupalliance.com/de

Brainjo: 2-Mio-EUR-Spritze für die Therapie-Brille

Lange Wartelisten und ein überlastetes Gesundheitssystem: Das Regensburger Start-up brainjo will die Lücken in der klassischen Psychotherapie mit Virtual Reality (VR) schließen.

Das Digital-Health-Start-up brainjo hat erfolgreich eine Seed-Finanzierung in Höhe von zwei Millionen Euro abgeschlossen. Angeführt wird die Finanzierungsrunde vom High-Tech Gründerfonds (HTGF). Zu den weiteren Geldgebern gehören die MEDICE Health Family als strategischer Partner sowie Business Angels, darunter der Regensburger Investor Andreas Weinhut und der Münchner VC better ventures. Mit dem frischen Kapital finanziert das Unternehmen den Start einer klinischen Studie und treibt die Zulassung seiner ersten digitalen Gesundheitsanwendung (DiGA) voran.

Von der Studenten-Idee zum Digital-Health-Start-up

Hinter brainjo steht ein zehnköpfiges, interdisziplinäres Team, das Expertise aus den Bereichen Technologie, Psychologie und Gesundheit vereint. Gegründet wurde die brainjo GmbH im Jahr 2022 mit Sitz in Regensburg. Die Wurzeln des Unternehmens liegen in einem Ausgründungsprojekt der Ostbayerischen Technischen Hochschule (OTH) Regensburg. Die Gründer – allen voran Christian Gnerlich, Alexander Pilling und Constantin Demigha – begannen bereits 2021 in der lokalen TechBase mit der Vision, Gehirntraining durch Virtual Reality greifbar zu machen.

Was als Projekt für generelle "Mental Fitness" startete, hat sich mittlerweile zu einem klinisch fundierten Ansatz im Bereich Digital Health weiterentwickelt. Heute lenken Markus Wensauer (Co-Founder und CEO) und Christian Gnerlich das operative Geschäft, während Alexander Pilling die VR-Entwicklung verantwortet.

Das Produkt: Psychotherapie im Gaming-Gewand

Brainjo entwickelt VR-basierte DiGAs für die Psychotherapie. Diese sollen künftig von Therapeut*innen oder Ärzt*innen verordnet und von den Krankenkassen erstattet werden. Der Ansatz des Start-ups ist es nicht, die klassische Psychotherapie zu ersetzen, sondern die teils gravierenden Versorgungslücken des Systems zu schließen. Patient*innen sollen so von zuhause aus Zugang zu einer immersiven und individualisierten Behandlungsform erhalten.

Die erste Anwendung richtet sich an Kinder mit ADHS und entsteht in direkter Kooperation mit der MEDICE Health Family. Um die oft geringe Therapiemotivation der jungen Zielgruppe zu knacken, setzt brainjo stark auf Gamification. Die Kinder tauchen per VR in virtuelle Welten ein und trainieren dort durch spielerische Elemente Alltagssituationen und kognitive Fähigkeiten. Laut HTGF-Principal Dr. Jörg Traub unterscheidet sich das Start-up genau durch diese Tiefe der Immersion von reinen Software-Lösungen, was einen klinisch relevanten Ansatz darstelle, um die Therapietreue (Adhärenz) signifikant zu steigern.

Der strategische Schachzug von MEDICE

Der Markt für Therapie auf Rezept (DiGA) ist in Deutschland stark umkämpft. Im Segment ADHS formiert sich bereits handfeste Konkurrenz:

- Bei Erwachsenen: Im Sommer 2025 wurde mit der App ORIKO (entwickelt von Takeda und MiNDNET) die erste DiGA für erwachsene ADHS-Patient*innen in das offizielle Verzeichnis des Bundesinstituts für Arzneimittel und Medizinprodukte (BfArM) aufgenommen.

- Im Kinder- und Jugendbereich: Mit hiToco existiert bereits ein etabliertes, Smartphone-basiertes Elterntraining für Kinder zwischen 4 und 11 Jahren (Zulassung ebenfalls Mitte 2025).

Besonders interessant: Hinter hiToco steht die medigital GmbH – eine Tochter der MEDICE Health Family. Der Einstieg von MEDICE bei brainjo ist daher mehr als nur ein finanzielles Investment. Der Pharmakonzern baut sich hier offensichtlich ein lückenloses, digitales ADHS-Ökosystem auf: hiToco für die Schulung der Eltern, brainjo für die direkte VR-Therapie der Kinder.

Unsere Einordnung

Der technologische Ansatz von brainjo ist vielversprechend und adressiert mit langen Wartelisten in der Psychotherapie ein massives gesellschaftliches Problem. Die strategische Einbettung in das MEDICE-Portfolio ist ein cleverer Hebel. Dennoch muss sich das Modell in den kommenden Jahren harten Herausforderungen stellen:

- Die Hardware-Hürde: Anders als eine einfache Smartphone-App erfordert die Lösung von brainjo teure VR-Brillen. Wer bezahlt die Hardware? Krankenkassen übernehmen in der Regel nur die Kosten für die reine DiGA-Nutzungslizenz. Wenn Eltern in Vorleistung gehen müssen oder ein aufwendiges Leih-System etabliert werden muss, verliert die Therapie ihren propagierten skalierbaren und einfachen Zugang.

- Zulassung und Zeitplan: Die Marktzulassung ist erst für 2028 geplant. Im schnelllebigen Start-up-Sektor ist das eine halbe Ewigkeit. Bis dahin muss brainjo mit den frischen zwei Millionen Euro den Betrieb sichern und vor allem die anstehende klinische Studie erfolgreich durchführen. Ohne wasserdichte Evidenzdaten platzt der Traum der BfArM-Zulassung.

- Akzeptanz bei Eltern und Behandler*innen: Eine immersive VR-Welt löst bei Kindern Begeisterung aus – bei Eltern potenziell Skepsis. Das Team muss pädagogisch überzeugend belegen, dass die zusätzliche „Bildschirmzeit“ unter der Brille einen rein therapeutischen Zweck erfüllt und eine ohnehin bestehende Reizüberflutung bei ADHS-Patient*innen nicht noch verstärkt.

Fazit

Brainjo verlässt die ausgetretenen Pfade der 2D-Apps und wagt sich an die hochkomplexe Schnittstelle zwischen VR-Hardware, Gaming und klinischer Therapie. Gelingt der klinische Wirksamkeitsnachweis und lässt sich die Verteilung der Hardware logistisch reibungslos organisieren, könnte das Start-up die Psychotherapie nachhaltig verändern. Bis 2028 bleibt dieses Vorhaben jedoch ein kapitalintensiver Ausdauerlauf.

Synera sichert sich 35 Mio. Euro für die Revolution des Engineerings

Was einst als bionisches Forschungsprojekt begann, ist heute eine der vielversprechendsten europäischen DeepTech-Hoffnungen. Doch wie tragfähig ist die Vision vom „autonomen digitalen Ingenieur“ im stark regulierten Maschinenbau? Ein tieferer Blick auf Gründer, Markt und das Geschäftsmodell.

Die deutsche Industrie steht unter massivem Druck: Internationale Konkurrenz – insbesondere aus Asien –, chronischer Fachkräftemangel und die Notwendigkeit, Entwicklungszyklen drastisch zu verkürzen, zwingen zum Handeln. Generative künstliche Intelligenz (GenAI) gilt als Heilsbringer, doch in der Praxis verpuffen viele Initiativen. Nur etwa 41 Prozent der KI-Prototypen in der Fertigungsindustrie erreichen laut Branchenstudien den produktiven Einsatz. Die Konstruktions- und Entwicklungsabteilungen gelten als stark in Silos organisiert und bis heute schwer automatisierbar.

„Engineering ist das Rückgrat jedes Industrieunternehmens, gehört jedoch nach wie vor zu den am wenigsten digitalisierten und automatisierten Funktionen und war bis vor Kurzem für KI weitgehend unzugänglich“, bringt es Dr. Moritz Maier, Co-CEO von Synera, auf den Punkt.

Genau in diese Lücke stößt sein Unternehmen. Mit einer Series-B-Finanzierungsrunde über 35 Millionen Euro will das Bremer Startup nun international skalieren. Angeführt wird die Runde vom europäischen Wachstumsfonds Revaia, mit starker Beteiligung des UVC Partners Wachstumsfonds sowie Capgemini (über ISAI Cap Ventures). Auch die Bestandsinvestoren Spark Capital, BMW iVentures und Cherry Ventures ziehen wieder mit. Das Signal an den Markt ist deutlich: Engineering Automation wird zum nächsten großen Software-Schlachtfeld.

Von Kieselalgen zur KI-Plattform

Hinter Synera stehen die Gründer Moritz Maier, Daniel Siegel (beide Co-CEO) und Sebastian Möller (Managing Director). Die Ursprungsidee entstand am renommierten Alfred-Wegener-Institut (AWI) in Bremerhaven. Die Gründer forschten dort im Bereich der Bionik und untersuchten die Leichtbaustrukturen von Kieselalgen, um deren evolutionäre Prinzipien auf technische Bauteile zu übertragen.

Aus „Evolutionary Light Structure Engineering“ wurde 2018 die Ausgründung ELISE. Zunächst lag der Fokus auf algorithmusbasiertem Design. Mit der Zeit erkannten die Gründer jedoch ein viel grundlegenderes Problem: Es fehlte nicht an Software für das eigentliche Design, sondern an einer Brücke, die die unzähligen Insellösungen (CAD, Simulation, Materialprüfung) im Engineering-Alltag verbindet. Dies führte zur Neuausrichtung und schließlich zur Umbenennung in Synera – einer Low-Code- und KI-Plattform für Connected Engineering.

Das Geschäftsmodell im Check

Synera betreibt ein klassisches B2B-Plattform-Modell. Anstatt etablierte Platzhirsche im Computer-Aided Design (CAD) zu verdrängen, positioniert sich Synera als übergeordnete Orchestrierungsschicht. Die Software klinkt sich in über 80 bestehende Tools ein.

- Der Werttreiber: Nutzer*innen können komplexe Workflows (z. B. CAD-Modellierung → Simulation → Kostenkalkulation → Designanpassung) als Templates speichern. Das frische Kapital soll laut Moritz Maier nun eine Entwicklung beschleunigen, „bei der KI-Agenten als echte digitale Engineers agieren und komplexe Workflows entlang der gesamten Wertschöpfungskette autonom ausführen.“

- Der Lock-in-Effekt: Wenn ein Industriekonzern seine Kernprozesse auf Synera automatisiert hat, ist die Plattform kaum noch auszutauschen. Die Wechselkosten für den Kunden sind enorm.

- Die Herausforderungen: Das Modell ist technisch hochkomplex. Die ständige Pflege von über 80 API-Schnittstellen zu Drittanbietern bindet gewaltige Entwickler*innen-Ressourcen. Zudem erfordert der Vertrieb in klassische Hardware-Unternehmen lange Sales-Zyklen.

Zwischen RPA und Spezial-CAD

Wettbewerbsumfeld | Marktansatz | Syneras Differenzierung |

Generatives Design (z. B. nTop, Altair) | Fokus auf die Erstellung hochkomplexer, gewichtsoptimierter Bauteile. | Synera generiert nicht nur das Design, sondern automatisiert den Prozess quer durch verschiedene externe Tools. |

Klassische RPA (z. B. UiPath, Zapier) | Hervorragend für kaufmännische Prozesse (HR, CRM, Rechnungen). | Standard-RPA scheitert an den komplexen 3D-Geometrie- und Physikdaten des Engineerings. |

PLM-Systeme (z. B. Siemens, Dassault) | Verwalten den gesamten Produktlebenszyklus und die Daten. | Synera setzt sich auf diese oft schwerfälligen Systeme, um die agilen Arbeitsschritte flexibler zu machen. |

Kritische Einordnung: Vertraut der/die Ingenieur*in der KI?

Synera verweist auf eine Umsatzverdopplung im vergangenen Jahr und über 60 namhafte Kunden, darunter BMW, Airbus, NASA und Miele. Mit dem frischen Kapital steht die Expansion nach Asien, Europa und in die USA an. Dass dieser Wachstumskurs von den Investoren aktiv gestützt wird, betont Benjamin Erhart, General Partner bei UVC Partners: „Wir konnten erleben, wie Synera als zuverlässiger Partner die Transformation des Engineerings gestaltet.“

Doch der Weg zur breiten Durchdringung birgt auch Stolpersteine:

- Das Vertrauensproblem: „Agentic AI“ bedeutet, dass die Software eigenständig Entscheidungen trifft. In sicherheitskritischen Branchen (Luftfahrt, Automotive) herrschen jedoch strikte Compliance-Regeln. Bevor ein KI-Agent autonome Designänderungen an tragenden Bauteilen vornimmt, müssen massive Haftungsfragen geklärt sein.

- Die Pilot-Falle: Viele GenAI-Projekte scheitern auf dem Weg in die Produktion. Die Gefahr für Synera besteht darin, in Innovationsabteilungen stecken zu bleiben, während das operative Kerngeschäft aus Kostengründen an bewährten Methoden festhält.

- Die API-Abhängigkeit: Wer als Brückenbauer*in zwischen Dutzenden Software-Silos agiert, macht sich von den Anbietern abhängig. Sperrt ein großer CAD-Anbieter seine API, trifft dies Syneras Modell im Kern.

Fazit

Synera ist ein exzellentes Beispiel dafür, wie aus akademischer Grundlagenforschung ein hoch skalierbares DeepTech-Produkt werden kann. Der strategische Pivot vom reinen Design-Tool zur prozessübergreifenden Plattform zahlt sich durch die starke Series B nun aus. Gelingt es den Bremern, den eher konservativen globalen Maschinenbau davon zu überzeugen, dass KI-Agenten die menschlichen Ingenieur*innen nicht ersetzen, sondern befähigen, könnte Synera der entscheidende globale Standard im Connected Engineering werden.

Strategischer Exit: food42morrow übergibt seine Getränkemarke JUMA an die Berentzen-Gruppe

Die Konsolidierung im Markt für funktionale Getränke setzt sich fort: die 2022 gegründete food42morrow GmbH übergibt ihre Marke JUMA im Rahmen eines strategischen Exits an die Vivaris Getränke GmbH & Co. KG, eine Tochtergesellschaft der börsennotierten Berentzen-Gruppe Aktiengesellschaft. Ab Mai 2026 soll die großflächige Skalierung unter der Flagge von Vivaris als JUMA Recharge+ erfolgen.

Die food42morrow GmbH wurde 2022 in Frankfurt am Main mit dem Ziel gegründet, Marktlücken im Bereich Functional Food durch wissenschaftlich fundierte und trendorientierte Konzepte zu schließen. Die Gründer Raoul Kammann, Max Kammann und Carlos Lopez Granado entwickelten mit JUMA eine Antwort auf die steigende Nachfrage nach natürlichen Wachmachern.

Das Kernprodukt RECHARGE+ ist ein teebasierter Hydration Drink, der Elektrolyte, Vitamine und natürliches Koffein (u. a. aus Guayusa) kombiniert. Der Fokus liegt hierbei auf einer Funktionalität ohne Zuckerzusatz, die speziell auf die Bedürfnisse einer urbanen, aktiven Zielgruppe zugeschnitten ist. Bereits 2025 konnte das Start-up die Marktfähigkeit durch erste Listungen im deutschen Lebensmitteleinzelhandel (LEH) nachweisen.

Packaging-Innovation als strategischer Hebel

Ein wesentliches Alleinstellungsmerkmal, das den Exit maßgeblich begünstigt haben dürfte, ist das innovative Gebinde. food42morrow brachte als erstes Unternehmen in Deutschland eine wiederverschließbare Aluminiumflasche mit Schraubverschluss in dieser Kategorie auf den Markt. Diese Verpackung kombiniert die hohe Recyclingquote von Aluminium mit der Flexibilität einer Flasche. Für etablierte Konzerne wie die Berentzen-Gruppe stellt eine solche bereits validierte „Hardware-Innovation“ einen hohen Wert dar, da sie das Risiko bei der Markteinführung neuer Kategorien senkt.

Einordnung: Die „Evolve 2030“-Strategie

Der Zukauf durch die Berentzen-Gruppe ist kein Zufall, sondern Teil einer breiteren Branchenbewegung. Mit der Strategie BERENTZEN EVOLVE 2030 reagiert der Konzern auf den rückläufigen Spirituosenkonsum und investiert massiv in das Segment der alkoholfreien Getränke (AfG). JUMA fungiert hierbei als Portfolio-Ergänzung im margenstarken Premium-Bereich der funktionalen Drinks. Ähnliche Strategien verfolgten zuletzt auch Akteure wie Eckes-Granini oder die Paulaner-Gruppe bei der Integration agiler Innovationsmarken.

Key Learnings für Gründer*innen

Aus dem Case food42morrow lassen sich drei zentrale Erkenntnisse für die Skalierung von Konsumgüter-Start-ups ableiten:

- USP durch Packaging: In einem gesättigten Markt reicht ein guter Inhalt oft nicht aus. Eine technologische oder funktionale Innovation bei der Verpackung kann der entscheidende Türöffner für den LEH und für Akquisitionsgespräche sein.

- Validierung vor Skalierung: Der Exit erfolgte erst, nachdem die Marktfähigkeit (Proof of Market) durch erste Listungen 2025 bewiesen war. Große Player kaufen bevorzugt Marken, die ihre „Kinderkrankheiten“ bereits überwunden haben.

- Positionierung als „Brückenbauer“: food42morrow hat sich erfolgreich als Bindeglied zwischen Start-up-Agilität und industrieller Skalierung positioniert. Dies ermöglicht es den Gründern, sich auf ihre Kernkompetenz – die Produktentwicklung – zu konzentrieren, während die massive Distribution durch die Strukturen eines Konzerns erfolgt.

Was kommt nach JUMA?

Mit der Übergabe der Marke an Vivaris stellt food42morrow seine Kompetenz als Innovationstaktgeber unter Beweis. Bleibt die spannende Frage, welche Trends das Frankfurter Team als Nächstes identifiziert.

Steckrübe statt Schwein: Verrano sichert sich hohe sechsstellige Finanzierung für die „Clean Label“-Revolution

Das 2023 gegründete Frankfurter Start-up Verrano hat ein neuartiges Verfahren entwickelt, das regionales Wurzelgemüse durch Reifung und Räucherung in eine pflanzliche Alternative zu Wurstersatzprodukten verwandelt.

Hinter Verrano, das Anfang 2023 in Frankurt/Main gegründet wurde, steht ein branchenerfahrenes, dreiköpfiges Gründerteam rund um Geschäftsführer Manuel Siskowski. Die Idee reifte jedoch schon lange vor der formellen Gründung. Getreu dem internen Motto „natürlich köstlich“ experimentierten die Gründer – zu denen auch Maximilian Bubenheim mit seiner Erfahrung aus der Sternegastronomie sowie Felix Linnenschmidt gehören – mehrere Jahre mit Wurzelgemüse.

Dabei wendeten sie ein Verfahren an, das in ähnlicher Form beim Reifen von klassischem Schinken zum Einsatz kommt. Nach ersten erfolgreichen Testläufen im regionalen Bio-Handel konnten bald die ersten Kund*innen mit Mengen aus der in Biebertal bei Gießen installierten Pilotanlage beliefert werden.

Handwerkstradition trifft Gemüse

Anstatt klassische Fleischersatzprodukte nachzuahmen, setzt Verrano auf die handwerkliche Veredelung. Regionale Rohstoffe wie Steckrübe, Sellerie und Rote Beete werden einem speziellen Fermentations- und Räucherverfahren unterzogen. Das Endprodukt zeichnet sich durch einen enormen Gemüseanteil von rund 95 Prozent aus und kommt mit nur wenigen Zutaten aus, ohne künstliche Zusatzstoffe zu verwenden. Das Ergebnis soll laut Unternehmensangaben in seiner Textur und dem Geschmack an hochwertige Fleischprodukte wie Schinken erinnern. Die kulinarischen Kreationen werden bereits als dünner Aufschnitt, im Würfelmix oder am Stück in den Markt eingeführt und eignen sich flexibel als Brotbelag, zum Kochen oder für Snackplatten. Die Innovationskraft dieses Ansatzes wurde kürzlich von PETA mit dem „VEGAN AWARD 2026“ in der Kategorie „beste vegane Innovation“ ausgezeichnet.

Eine neue Kategorie jenseits der Imitation

Der Markt für pflanzliche Alternativen konsolidiert sich aktuell, während die Lebensmittelbranche verstärkt nach innovativen pflanzlichen Produkten sucht, die neue Geschmackserlebnisse erzeugen. Hier positioniert sich Verrano in der stark wachsenden Nische der „Clean Label“-Produkte. Direkte Wettbewerber*innen mit einem identischen Ansatz sind rar, da die meisten großen Player*innen weiterhin auf Extrusionsverfahren von Proteinisolaten setzen. Verrano erschafft vielmehr eine neue Kategorie: Eine pflanzliche Feinkost, die das Naturprodukt Gemüse transformiert. Dass diese Nische massentauglich ist, bewies das Start-up jüngst im Veganuary durch aufmerksamkeitsstarke Listungen deutschlandweit in den Bordbistros der Deutschen Bahn.

Die Herausforderungen am Markt

Trotz der vielversprechenden Traction und der Skalierbarkeit, die bereits mit der Pilotanlage bewiesen wurde, steht das Start-up vor großen operativen Herausforderungen, um den Start im breiten Handel zu ermöglichen. Ein Reifeprozess, der Wochen in Anspruch nimmt, bindet extrem viel Working Capital, da enorme Mengen vorproduziert und gelagert werden müssen. Zudem verhält sich Gemüse im Reifeprozess mikrobiologisch grundlegend anders als Fleisch. Die Qualitätssicherung erfordert hochpräzise Produktionsumgebungen, um die Haltbarkeit bei größeren Mengen zu garantieren. Letztlich bedarf es auch starker Aufklärungsarbeit und forcierter Vertriebsaktivitäten am Konsument*innen, um Wurzelgemüse dauerhaft als Premium-Feinkostprodukt zu etablieren.

Reale Skalierung statt VC-Hype

Genau bei diesen Herausforderungen zeigt sich die strategische Passung der aktuellen Finanzierungsrunde. Dass Verrano die bestehenden Produktionskapazitäten massiv ausweiten muss, um die ansteigende Nachfrage zu bedienen, ist der klassische Flaschenhals von Food-Start-ups. Der überwiegende Teil der eingeworbenen Mittel fließt in genau diesen Zweck. Dass die Finanzierungsrunde dabei, wie StartingUp aus Branchenkreisen erfuhr, im hohen sechsstelligen Bereich liegt, beweist die Kapitaleffizienz des Unternehmens. Anstatt reines Risikokapital in teure Eigenentwicklungen zu pumpen, setzt Verrano auf „Smart Money“.

Mit dem Maschinenbauer Weber Food Technology und der Wurst- und Schinkenmanufaktur Bedford holen sie sich zwei strategische Industrie-Schwergewichte an Bord. Verrano profitiert hier direkt von jahrzehntelanger Expertise in der mikrobiologischen Reifung sowie im industriellen High-Tech-Slicing. Zusammen mit der BMH, die als VC-Tochter der Helaba aktuell Fonds mit einem Volumen von 450 Millionen Euro verwaltet, hat das Start-up starke Partner für die anstehende Geschäftsentwicklung gewonnen. Dieses Konsortium bietet das Rüstzeug, um die Nische der veganen Boutiquen zu verlassen und den Lebensmitteleinzelhandel zu adressieren.

Griff nach den Sternen: Lieferando- und Tier-Mitgründer sammelt 5 Mio. Euro für Solarenergie aus dem All

Das europäische Start-up TerraSpark will sauberen Strom per Funk aus dem Orbit zur Erde schicken. Mit dabei: der Deutsche Matthias Laug, Mitgründer von Lieferando und Tier Mobility, sowie deutsche Investoren. Wir wollten wissen: Wie realistisch ist das ehrgeizige Vorhaben der Tech- und Raumfahrt-Veteranen? Eine Einordnung.

Europas Energieinfrastruktur stößt zunehmend an ihre Grenzen. Während die Internationale Energieagentur (IEA) prognostiziert, dass sich der Strombedarf von Rechenzentren bis 2030 mehr als verdoppeln wird, zeigten großflächige Stromausfälle in Spanien und Portugal zuletzt die Schwächen der heutigen Energiesysteme auf.

Eine radikale Lösung für dieses drängende Problem verspricht nun das 2025 in Luxemburg gegründete Start-up TerraSpark. Das junge Unternehmen hat eine Pre-Seed-Finanzierungsrunde in Höhe von über fünf Millionen Euro erfolgreich abgeschlossen. Zu den Geldgebern zählen neben der Pariser Gesellschaft Daphni und dem Tech-Investor Sake Bosch auch die Angel-Investoren-Allianz better ventures und die Hans(wo)men Group. Ihr gemeinsames Ziel: Weltraumgestützte Solarenergie kommerziell nutzbar zu machen.

Prominente deutsche Wurzeln in einem hochkomplexen Hardware-Projekt

Dass dieses Vorhaben für die hiesige Gründerszene von besonderem Interesse ist, liegt maßgeblich an der personellen Aufstellung. Hinter TerraSpark steht ein Gründertrio, das eine seltene Kombination aus europäischer Raumfahrtexpertise und massiver Skalierungserfahrung vereint. Aus deutscher Sicht sticht hierbei besonders Chief Operating Officer Matthias Laug hervor. Als Mitgründer von Lieferando und Tier Mobility bringt er tiefe Erfahrung im Aufbau und in der Skalierung großer europäischer Plattformunternehmen in das komplexe Projekt ein.

Geführt wird das Team von CEO Jasper Deprez, einem Seriengründer, der zuvor die globale HR-Tech-Plattform Tradler aufbaute. Die zwingend notwendige Raumfahrt-Expertise liefert Chief Technology Officer Dr. Sanjay Vijendran: Er verantwortete bei der Europäischen Weltraumorganisation (ESA) bereits das Solaris-Programm zur weltraumgestützten Solarenergie und war an der Mars Sample Return Mission beteiligt. Auch auf Investor*innenseite ist das deutsche Vertrauen in das Team groß. Tina Dreimann, Gründerin und Geschäftsführerin von better ventures, lobt genau diese Mischung aus europäischer Raumfahrtkompetenz und der Erfahrung, Technologie wirklich zu skalieren.

Erst die Erde, dann das All

Die Vision des Trios ist gewaltig: Solarenergie soll im Weltraum eingefangen und per Funkfrequenz sicher zur Erde übertragen werden. Das Konzept ist in der Theorie bereits seit den 1970er Jahren bekannt, doch erst heute machen sinkende Startkosten sowie technologische Fortschritte in der Satellitenfertigung und Orbitrobotik die Umsetzung wirtschaftlich tragfähig.

Anstatt jedoch das immense Risiko einzugehen und sofort mit gigantischen Systemen im All zu beginnen, wählt TerraSpark bewusst einen schrittweisen Kommerzialisierungs-Ansatz. Das Startup startet auf der Erde mit der Kommerzialisierung funkfrequenzbasierter drahtloser Energieübertragung für industrielle Anwendungsfälle. Mit diesem pragmatischen Schritt sollen Sicherheit, Effizienz und regulatorische Kompatibilität im kleinen Maßstab demonstriert werden, bevor das System in den Orbit skaliert wird. Ein hochrelevanter Markt für diese erste Phase sind netzferne Regionen, die bislang auf Dieselgeneratoren angewiesen sind. Dort liegen die Stromkosten häufig bei etwa 0,70 bis 1,50 Euro pro Kilowattstunde – ein starkes Preissignal, das technologische Alternativen rasch wirtschaftlich attraktiv machen kann.

Um diesen Markt zu erschließen, bereitet das Unternehmen in den kommenden Monaten erste Pilotanwendungen vor, darunter die drahtlose Energieversorgung eines Live-Events. Auch die Roadmap für den Weg ins All steht: Ein erster orbitaler Technologie-Demonstrator ist für das Jahr 2027 geplant, die erste echte Weltraum-zu-Erde-Energieübertragung wird für 2028 anvisiert.

Markt, Wettbewerb & Machbarkeit

Obwohl die Physik hinter der funkfrequenzbasierten Energieübertragung laut CTO Sanjay Vijendran seit Jahrzehnten validiert ist, bleibt die weltraumgestützte Solarenergie ein extrem komplexes Unterfangen. TerraSpark ist auf diesem kapitalintensiven Spielfeld nicht allein. Neben Start-ups wie Virtus Solis aus den USA oder dem neuseeländisch-deutschen Unternehmen Emrod haben auch etablierte Luft- und Raumfahrtgiganten wie Airbus das enorme wirtschaftliche Potenzial längst erkannt und treiben eigene Forschungsprogramme voran.

Kritisch zu hinterfragen bleibt bei all diesen Vorhaben die technische Effizienz der Energieübertragung über gewaltige Distanzen bis hinunter zur Erde. Die Errichtung großflächiger Solarpaneele im Weltall erfordert trotz signifikant sinkender Frachtpreise weiterhin immense Vorabinvestitionen und unzählige Raketenstarts. Zudem muss der internationale regulatorische Rahmen für das Richten von hochkonzentrierten Funkwellen aus dem All auf irdische Empfangsstationen erst noch global abgestimmt werden.

Fazit

Der „Earth-first“-Ansatz von TerraSpark ist ein äußerst kluger, unternehmerischer Schachzug. Er mildert das finanzielle Risiko für die Seed-Investoren ab, demonstriert Technologie greifbar im Kleinen und könnte frühe B2B-Umsätze generieren, lange bevor die erste Hardware ins All fliegt. Dennoch bleibt der Meilenstein-Plan enorm ambitioniert. Matthias Laug und seine Mitstreiter*innen haben in der Vergangenheit zwar eindrucksvoll bewiesen, dass sie digitale und urbane Geschäftsmodelle massiv skalieren können. Der Schritt vom E-Scooter-Verleih zur interplanetaren Energie-Infrastruktur erfordert in den kommenden Jahren jedoch eine völlig neue Dimension der Exekution – und noch deutlich tiefere Taschen der Investor*innen.

cuisyn schließt Finanzierungsrunde ab und startet Gastro-Roll-up im Rhein-Main-Gebiet

Das Frankfurter Start-up cuisyn hat sich frisches Kapital gesichert und übernimmt auf einen Schlag sieben Traditionsbetriebe. Nun soll das Modell auf die Individualgastronomie übertragen werden. Eine spannende Wette auf Skaleneffekte im Hintergrund – doch lässt sich der Charme eines Einzelrestaurants wirklich in ein Konzernkorsett pressen?

Das von der blueworld.group gegründete Gastronomie-Unternehmen cuisyn hat eine neue Finanzierungsrunde abgeschlossen. Als neuer strategischer Investor steigt die Beteiligungsgesellschaft Summiteer ein, die von Ex-Akasol-CEO Sven Schulz gegründet wurde und von Geschäftsführer Dominik Bär geleitet wird.

Mit dem frischen Kapital (über die Höhe wurden keine Angaben veröffentlicht) beschleunigt cuisyn seine Buy-and-Build-Strategie massiv und verkündet die Übernahme von sieben weiteren Betrieben im Rhein-Main-Gebiet. Konkret handelt es sich dabei um:

- das IZU Asian Bistro,

- das Hotel und Restaurant Paulaner am Dom,

- die Oberschweinstiege,

- die Zur Käsmühle,

- sowie die Lokale Paulaner und Little Italy im Gebäude THE SQUAIRE.

Durch diese gezielten Zukäufe verdreifacht die Gruppe ihren Umsatz im Vergleich zum Vorjahr und plant bereits die nächste Expansionsphase in weitere deutsche Städte.

Team & Gründungshistorie

Hinter der im Jahr 2021 gegründeten Dachgesellschaft Mutti freut sich GmbH steht eine Mischung aus Serial Entrepreneuren und Gastro-Veteranen. Dr. Rigbert Fischer, der als Gründer und Geschäftsführer agiert, bringt die Blaupause für das Geschäftsmodell mit: Mit seiner blueworld.group formte er bereits das „Haus der Bäcker“ durch gezielte Nachfolgelösungen zu einer schlagkräftigen Gruppe.

Markus Langkamm steuert als weiterer Geschäftsführer die operative Branchenexpertise bei, nachdem er zuvor zahlreiche Konzepte für die renommierte Gekko Group entwickelte und führte. Ergänzt wird das Führungsteam unter anderem durch Matthias Kapaun (Process Development), ehemals Managing Director bei GO by Steffen Henssler, sowie durch die HR-Managerin Hannah Issing.

Die Front bleibt individuell, das Backend wird Systemgastro

Der Kernansatz von cuisyn ist es, erfolgreiche, individuelle Gastronomiebetriebe zu kaufen und deren Einzigartigkeit, Werte und Historie zu erhalten. Dem Gast soll im Restaurant nicht auffallen, dass er sich in einem stark systematisierten Filialbetrieb befindet.

Das Versprechen an die übernommenen Betriebe lautet, die Individualgastronomie zukunftsfähig zu machen, indem die Stärken der Systemgastronomie im Hintergrund genutzt werden. Während sich die Teams vor Ort auf die Kernkompetenzen Service und Küche fokussieren, zentralisiert und digitalisiert cuisyn die sekundären Prozesse. Dazu gehören:

- Digitale Systeme und IT,

- Finanzen und Controlling,

- Marketing und Employer Branding,

- Personalbeschaffung,