Aktuelle Events

Climate-Tech-Start-up SQUAKE sichert sich 3,5 Mio. Euro Wachstumskapital

Das 2020 von Philipp von Lamezan und Dan Kreibich gestartete Berliner Climate-Tech-Start-up bietet akkurate Emissionsberechnungen und Reduktionsmaßnahmen für Reise- und Logistikemissionen an.

SQUAKE gibt heute bekannt, dass es mit Simon Capital als Lead unter Beteiligung von Schenker Ventures und Rivus Capital eine Finanzierungsrunde in Höhe von 3,5 Millionen Euro abgeschlossen hat. Auch die bestehenden Investoren Neosfer und Backbone Ventures sowie die Business Angels Michael Riegel und Matthäus Niewodniczanski haben sich an der Finanzierungsrunde beteiligt und schließen sich der Kapitalbeteiligung der Lufthansa Group an.

Das frische Kapital, mit dem sich die bisherige Gesamtfinanzierung von SQUAKE auf 5 Millionen Euro erhöht, wird für technologische Forschung und Entwicklung sowie für die Einstellung neuer Mitarbeiter verwendet, um der wachsenden Nachfrage gerecht zu werden sowie das Wachstum in strategischen Märkten voranzutreiben.

Das 2020 von Philipp von Lamezan (CEO) und Dan Kreibich (CPO) gestartete Berliner Unternehmen SQUAKE, das aus dem Lufthansa Innovation Hub hervorgegangen ist, arbeitet seit 2021 unabhängig. Über eine Programmierschnittstelle (API) fügt sich SQUAKE nahtlos in das Backend jeder digitalen Infrastruktur ein, um präzise Emissionsberechnungen für jegliche Reise- und Logistikaktivitäten – wie etwa Flüge, Lieferungen, Autovermietung und Hotels – auf Grundlage nationaler und internationaler Standards zu ermöglichen. Dabei überbrückt SQUAKE zusammen mit den Kund*innen und Partner*innen die enorme Lücke im Emissionsbewusstsein dieser Branchen, indem es auf nachhaltigere Möglichkeiten hinweist und so eine informationsbasierte Entscheidungsfindung ermöglicht.

Trotz eines breiteren Angebots an umweltfreundlicheren Alternativen sind die CO2-Emissionen nach wie vor hoch, weshalb Reduktions- & Kompensationsmaßnahmen erforderlich sind. SQUAKE konzentriert sich mit seinem Portfolio hauptsächlich auf die Kohlenstoffentfernung und -speicherung. Indem SQUAKE Kund*innen mit geprüften und etablierten Partner*innen auf der ganzen Welt verbindet – darunter Anbieter*innen von nachhaltigen Flugkraftstoffen, Direct Air Capture und Aufforstung – automatisiert SQUAKE den Prozess der Kohlenstoffentfernung und -speicherung. Durch ein streng qualifiziertes Partnernetzwerk macht SQUAKE wirksame Klimaschutzmaßnahmen so für Unternehmen und ihre Kund*innen zugänglich.

Endnutzende wie Reisende und Logistikeinkäufer*innen haben so die Möglichkeit, pragmatisch mit ihren Emissionen umzugehen, da die SQUAKE-Technologie in die Infrastruktur von Unternehmen integriert wird – von Buchungstools und Reisebüros bis hin zu Logistik-Plattformen. Darüber hinaus wird durch die Zusammenarbeit mit externen Prüfer*innen die Datensicherheit der Plattform optimiert und so Bewusstsein und Vertrauen unter den Kund*innen geschaffen.

Philipp von Lamezan, CEO und Co-Founder von SQUAKE, kommentiert: „Die nachhaltige Transformation der Reise- und Logistikbranche steht vor vielen Herausforderungen. Die EU hat sich zum Ziel gesetzt, die Kohlendioxidemissionen bis 2030 um 55 Prozent gegenüber 1990 zu senken. Vor wenigen Wochen wurde jedoch bekannt, dass die globale Erwärmung zum ersten Mal die wichtige Grenze von 1,5 Grad überschreiten wird. Angesichts des zunehmenden Drucks von Kunden, Wettbewerbern und Investoren unterstützen wir Unternehmen – so schnell wie möglich, um einen Wandel zu schaffen.“

„Zwar wurden Verbesserungen in der Lieferkette erzielt – von nachhaltigen Kraftstoffen über die Optimierung von Motoren bis hin zur Reduzierung von Kunststoffen – doch fehlt es den Entscheidungsträgern in allen Bereichen immer noch an wichtigen Kenntnissen, um nachhaltigere Kaufentscheidungen zu treffen. Nachhaltigkeit und Wirtschaft gehen Hand in Hand, aber Vertrauen ist entscheidend, damit diese Partnerschaft funktioniert. Unsere Investoren und Unternehmenspartner sind ein Beweis für das Vertrauen, das wir bereits aufgebaut haben. Aber es gibt noch viel zu tun und wir dürfen keine Zeit mehr verlieren.“

Jan Leicht, Partner bei Simon Capital, fügt hinzu: „Die Mobilität von Menschen und Gütern steht im Zentrum unseres täglichen Lebens und wird es auch weiterhin erschweren, unsere CO2-Emissionen zu verringern. Für uns hebt sich SQUAKE durch seine einzigartige Unternehmensgeschichte deutlich von seinen Mitbewerbern ab. Es ist aus der Reise- und Logistikbranche hervorgegangen und wurde für diese entwickelt. Die Tatsache, dass Branchengrößen wie Reed & Mackay, HomeToGo oder DB Schenker Partner von SQUAKE sind, ist eine Anerkennung für das beeindruckende Produkt und bedeutet, dass bereits heute Millionen von Menschen von der bereitgestellten Technologie profitieren können.“

Paulina Banszerus, Head of Venture Capital bei Schenker Ventures: „Wir sind beeindruckt durch die von SQUAKE entwickelte Technologie. Wir sehen großes Potenzial, die nachhaltige Transformation unserer Industrie mit dieser Lösung voranzutreiben.“

Diese Artikel könnten Sie auch interessieren:

ENVIOTECH sichert sich Millionenfinanzierung für intelligente öffentliche Straßenbeleuchtung

Das Frankfurter Start-up ENVIOTECH rund um Adrian Rhaese, Linh Pham, Dustin Arnold und Peter Kletsko hat eine Pre-Seed-Runde in Höhe von einer Million Euro abgeschlossen, um öffentliche Straßenbeleuchtung intelligent nachzurüsten. Doch der Markt für kommunale Infrastruktur ist hart umkämpft und bürokratisch. Kann das junge Team die öffentlichen Verwaltungen überzeugen?

Es ist ein klassisches Gründer*innen-Narrativ: Aus einem persönlichen Schmerzpunkt entsteht eine Geschäftsidee. Im Fall von ENVIOTECH war es ein Fahrradunfall. Der beste Freund von Mitgründer Adrian Rhaese verunglückte, weil in einer deutschen Stadt die Straßenlaternen aufgrund gestiegener Stromkosten abgeschaltet worden waren. Dieser Vorfall weckte bei Rhaese das Unverständnis darüber, dass in einem wirtschaftlich starken Land ausgerechnet an der Sicherheit gespart wird – und legte den Grundstein für das Smart-City-Start-up.

Bye-bye Bankenturm: Der Sprung ins kalte Wasser

Anstatt ihren als sicher geltenden Karriereweg fortzusetzen, verließen Adrian Rhaese und Mitgründerin Linh Pham ihre Positionen als duale Studierende bei der Deutschen Bank. Sie entschieden sich bewusst für das unternehmerische Risiko, um reale Infrastrukturprobleme zu lösen.

Eine erste Bestätigung für diesen Schritt erhielt das junge Team durch die Aufnahme in das EWOR Fellowship. Daniel Dippold, Gründer und CEO von EWOR, bescheinigt dem Team den richtigen Fokus: „Unspektakuläre Infrastruktur gewinnt langfristig fast immer. Straßenbeleuchtung ist nicht glamourös, aber sie ist allgegenwärtig, unverzichtbar und aus keiner Stadt wegzudenken.“

Plug-and-Play am Lichtmast: Das 15-Minuten-Update

Die technische Lösung von ENVIOTECH setzt auf Pragmatismus: Anstatt Laternen kostenintensiv komplett auszutauschen, bietet das Unternehmen ein Retrofit-System an. Das Produkt soll sich laut Unternehmensangaben in unter 15 Minuten in bestehende Leuchten integrieren lassen.

Die nachgerüsteten Laternen kommunizieren als Mesh-Netzwerk miteinander und dimmen das Licht KI-gesteuert und bedarfsgerecht anhand von Bewegungserkennung. Das Startup verspricht dadurch Energieeinsparungen von bis zu 80 Prozent; gleichzeitig soll die öffentliche Sicherheit erhöht werden. Kommunen erhalten so die Möglichkeit, ihre Beleuchtung zentral zu steuern und in Echtzeit zu überwachen.

Um das Konzept in die Fläche zu tragen, konnte ENVIOTECH nun eine Pre-Seed-Finanzierung in Höhe von 1 Million Euro einsammeln. Angeführt wird die Runde passenderweise vom ehemaligen Co-CEO der Deutschen Bank, Jürgen Fitschen. Ergänzt wird das Konsortium durch Ex-MAN-CEO Joachim Drees, Alexander Eyhorn (Gründer von Bidirex) und Danilo Jovicic-Albrecht (Mitgründer des auf Kommunen spezialisierten Startups Vialytics). Mit dem frischen Kapital sollen Pilotprojekte forciert und das Technologieportfolio weiterentwickelt werden.

Der Endgegner heißt B2G-Markt: David gegen die Industrie-Goliaths

So einleuchtend die Technologie klingt, das Geschäftsmodell von ENVIOTECH steht vor gewaltigen Hürden. Der B2G-Markt (Business-to-Government) ist für Start-ups extrem schwierig. Kommunen, die ENVIOTECHs primäre Zielgruppe darstellen, arbeiten mit langen Budgetzyklen und streng regulierten öffentlichen Ausschreibungsverfahren. Bis ein Pilotprojekt zu einem flächendeckenden Rollout führt, vergehen oft Jahre.

Darüber hinaus agiert das Start-up nicht im luftleeren Raum. Der Smart-Lighting-Markt wird von Industriegiganten wie Signify oder Schréder dominiert, die längst eigene IoT-Lichtsteuerungssysteme anbieten. Auch andere Start-ups wie Tvilight oder Icegateway haben das Potenzial vernetzter Straßenbeleuchtung erkannt.

Der entscheidende USP von ENVIOTECH muss daher in der Geschwindigkeit und Einfachheit liegen: Gelingt die versprochene rasante Installation und können Kommunen die Lösung ohne massive Tiefbauarbeiten testen, hat das Start-up einen echten Wettbewerbsvorteil. Besonders klug ist hierbei die Auswahl der Investor*innen: Mit Drees und Jovicic-Albrecht hat das Gründerduo Köpfe an Bord geholt, die wissen, wie man komplexe Produkte an die öffentliche Hand verkauft. Schafft es ENVIOTECH, den extrem zähen Vertriebszyklus öffentlicher Verwaltungen zu knacken, könnte das Unternehmen zu einem hochrentablen Hidden Champion heranwachsen.

Primogene: 4,1 Mio. Euro für den Muttermilch-Code – Deep-Tech-Innovation oder riskantes Unterfangen?

Das Leipziger BioTech-Start-up Primogene hat eine Seed-Finanzierung in Höhe von 4,1 Mio. Euro eingesammelt, um komplexe bioaktive Moleküle im industriellen Maßstab auf den Markt zu bringen.

Während die Unternehmenskommunikation den Durchbruch einer neuen Plattformtechnologie feiert, zeigt ein genauerer Blick auf den globalen Markt für humane Milcholigosaccharide (HMOs) ein Haifischbecken voller multinationaler Konzerne. Eine kritische Analyse des Geschäftsmodells, der Gründer*innen und des Wettbewerbs.

DeepTech Made in Leipzig

Hinter Primogene stehen Dr.-Ing. Reza Mahour (CEO), Valerian Grote und Linda Karger (COO), die das Unternehmen 2023 in Leipzig gründeten. Die Zusammensetzung des Teams vereint technologische und wissenschaftliche Expertise, um die ehrgeizige Vision einer industriellen Enzym-Produktion umzusetzen. Die aktuelle, 4,1 Millionen Euro starke Seed-Runde wird vom High-Tech Gründerfonds (HTGF) angeführt. Zum Investoren-Konsortium gehören außerdem der Technologiegründerfonds Sachsen (TGFS), better ventures, die Sächsische Beteiligungsgesellschaft (SBG), die Golzern Holding GmbH, die FS Life Science Investment GmbH sowie Dr. Marc Struhalla, Gründer und CEO der c-LEcta GmbH. Der Kapitaleinsatz ist klar definiert: Die neuen Mittel fließen in den Ausbau des IP-Portfolios, die Erweiterung der Produktionskapazitäten in Leipzig und in strategische Partnerschaften.

Das Modell im Stresstest: Die Kostenfalle der Enzyme

Primogene hat eine enzymatische Plattformtechnologie entwickelt, um Inhaltsstoffe zu produzieren, die identisch zu natürlichen Molekülen sind – nachhaltig und kosteneffizient. Im Zentrum stehen dabei komplexe humane Milcholigosaccharide (HMOs) wie Disialyllacto-N-Tetraose (DSLNT) und Difucosyllacto-N-Tetraose I (LNDFH I). Laut Primogene verursachen etablierte fermentative Herstellungsverfahren erhebliche Kosten und stoßen bei der Produktion derartiger hochkomplexer Moleküle an ihre Grenzen.

Der Lackmustest: Die Prämisse, dass enzymatische Verfahren in der Massenproduktion überlegen sind, birgt in der Praxis massive Hürden. Die Entwicklung und wirtschaftliche Produktion der benötigten Enzyme selbst ist extrem kapitalintensiv. Dass das Start-up den gesamten Prozess – von der Enzymentwicklung über die Produktion und Biotransformation bis zur Aufreinigung – komplett am eigenen Unternehmensstandort in Leipzig abbilden will, ist ein ambitionierter, aber riskanter Schritt. Der Aufbau eigener Produktionsanlagen für komplexe BioTech-Prozesse führt oft zu einer enorm hohen Kapitalverbrennungsrate (Burn Rate).

Erste kommerzielle Meilensteine dämpfen dieses Risiko jedoch: Erste Inhaltsstoffe für Kosmetikprodukte wurden mit Kooperationspartnern entwickelt und sind bereits kommerziell erhältlich. Auch pharmazeutische Rohstoffe befinden sich aktuell im Test bei Kund*innen. Zudem erforscht das Unternehmen in Zusammenarbeit mit dem Fraunhofer-Institut für Zelltherapie und Immunologie (IZI) in Leipzig das Potenzial seiner Inhaltsstoffe zur Prävention von Infektionskrankheiten.

Im Haifischbecken: Auf Kollisionskurs mit den Lebensmittel-Riesen

Der Zielmarkt ist hochattraktiv: Der globale HMO-Markt wächst jährlich um etwa 18 bis 20 Prozent, und über 65 Prozent der im Jahr 2023 neu eingeführten Säuglingsnahrungsprodukte enthielten mindestens ein HMO. Neben der Säuglingsernährung bedient Primogene auch Märkte wie die Darmgesundheit bei Erwachsenen, die Gedächtnisverbesserung im Alter sowie funktionale Inhaltsstoffe für Körperpflege und pharmazeutische Rohstoffe.

Das Leipziger Team trifft in der Nahrungsmittelindustrie jedoch auf einen extrem konsolidierten Markt, der von Milliarden-Konzernen dominiert wird. Einer der größten B2B-Zulieferer für Säuglingsnahrung weltweit ist DSM-Firmenich (mit der übernommenen Sparte Glycom), der den Markt durch gigantische Größenvorteile (Economies of Scale) in der Fermentation beherrscht. Auch Chr. Hansen (Jennewein), ein Pionier in der mikrobiellen HMO-Synthese, stellt mit seiner extrem tiefen Integration bei Lebensmittelriesen einen massiven Konkurrenten dar. Auf der Abnehmerseite agieren Endkonsument*innen-Giganten und Branchenführer wie Nestlé und Abbott, bei denen für einen neuen Zulieferer von Inhaltsstoffen extrem hohe regulatorische und volumenbasierte Hürden bestehen.

Primogenes strategische Nische: Ein Preiskampf bei einfach strukturierten Standard-HMOs gegen die großen Fermentations-Player wäre für ein Start-up kaum zu gewinnen. Primogenes entscheidender Wettbewerbsvorteil liegt jedoch in der Komplexität. Die industrielle Produktion von Molekülen wie DSLNT – das laut klinischen Studien signifikante gesundheitliche Vorteile speziell für Frühgeborene bietet – war bislang schlicht nicht möglich. Wenn Primogene hier durch sein starkes Patentportfolio die technologische Lücke schließt, umgeht das Unternehmen den harten Konkurrenzkampf im Massenmarkt.

Unser Fazit: Hohes Risiko, riesiger Hebel

Primogene ist kein schlankes Software-Projekt, sondern waschechtes DeepTech. Das bedeutet: Hohe regulatorische Hürden, langer Atem in der Forschung und massive Kapitalanforderungen. Die Seed-Finanzierung in Höhe von 4,1 Millionen Euro ist ein starker Vertrauensbeweis erfahrener Investoren, wird für den Anlagenbau und die Skalierung der Leipziger Produktion auf Dauer jedoch kaum ausreichen. Primogene muss nun rasch beweisen, dass die enzymatische Synthese nicht nur technologisch überlegen, sondern auch unter realen industriellen Kostendrücken skalierbar ist. Gelingt dieser Proof of Concept, hält das Start-up den Schlüssel zu einer neuen Generation komplexer, bioaktiver Moleküle in der Hand.

110-Mio.-Dollar-Turbo: Sereact verpasst Robotern eine Vorstellungskraft

Mit 110 Mio. Dollar frischem Kapital und „Cortex 2“ greift das Stuttgarter Start-up Sereact die USA an. Die Vision: Roboter, die physikalisch mitdenken, statt nur blind zuzugreifen.

Das 2021 gegründete Stuttgarter Start-up Sereact hat in einer aktuellen Serie-B-Finanzierungsrunde 110 Millionen US-Dollar eingesammelt. Mit dem Versprechen, Industrierobotern durch sogenannte „Weltmodelle“ eine Art situative Vorstellungskraft zu verleihen, zieht das Unternehmen erneut internationale Schwergewichte an. Doch während die Kriegskasse für die anstehende US-Expansion prall gefüllt ist, stellt sich die Frage: Kann der datengetriebene Ansatz aus dem Schwabenland die hochfinanzierte US-Konkurrenz auf ihrem Heimatmarkt wirklich ausstechen? Eine Analyse.

Millionen-Spritze für den Weltmarkt

Die Gründungsgeschichte von Sereact liest sich wie ein europäischer Tech-Traum. Ralf Gulde (CEO) und Marc Tuscher (CTO) starteten 2021 als Ausgründung der Universität Stuttgart. Was mit improvisierten Servern aus gebrauchten Grafikkarten begann, hat sich zu einem globalen Geschäft entwickelt: Nach einer Serie-A-Runde im Jahr 2025 führt nun der VC Headline die 110-Millionen-Dollar-Runde an. Beteiligt sind zudem Bullhound Capital, Daphni und Felix Capital, womit das Gesamtkapital auf über 140 Millionen US-Dollar steigt.

Der Grund für das massive Interesse liegt in der Skalierbarkeit: Mit über 200 europaweit eingesetzten Systemen gilt Sereact als einer der am häufigsten eingesetzten Anbieter von KI-Kommissionierrobotern. Die Kundenliste umfasst Größen wie BMW, Mercedes-Benz, DHL, PepsiCo und die Österreichische Post.

Cortex 2: Denken vor dem Greifen

Bisher basierte der Erfolg auf der Koppelung von Sprachmodellen und Bilderkennung. Mit der neuen Generation „Cortex 2“ geht Sereact einen Schritt weiter: Das System erweitert ein Vision-Language-Action-Modell (VLA) um ein „Weltmodell“. Anstatt nur zu reagieren, gleicht die KI Aktionen mit einem erlernten Modell der Physik ab und wählt den vielversprechendsten Weg aus.

Dieser Wechsel vom Reagieren zum Schlussfolgern ermöglicht komplexe Aufgaben, bei denen feinfühliger Kontakt entscheidend ist – etwa das Zusammenbauen von Komponenten unter Spannung oder das kratzerfreie Anbringen eines Scheibenwischers. CTO Marc Tuscher betont: „Wir bauen keine Roboter. [...] Die Hardware wird zur Massenware. Das Modell nicht.“

Der Eine-Milliarde-Picks-Vorsprung

Sereact positioniert sich als reines Software-Unternehmen, sieht seinen entscheidenden Vorteil jedoch in der Datenqualität. Ein kritischer Blick auf den Markt zeigt:

- Reale Daten vs. Simulation: Während viele Wettbewerber mit simulierten Daten trainieren, wurde Cortex 2 auf Basis von mehr als einer Milliarde realer Greifvorgänge aus der Produktion entwickelt.

- Nachgewiesene Präzision: Sereact begegnet der Skepsis gegenüber KI in der Logistik mit harten Zahlen. Laut Unternehmen erfordert nur noch jeder 53.000. Kommissioniervorgang ein menschliches Eingreifen.

- Hardware-Abhängigkeit: Trotz der Software-Stärke bleibt Sereact darauf angewiesen, dass Kunden in moderne Roboterarme und Sensorsysteme wie die hauseigene „Sereact Lens“ investieren.

Showdown in den USA

Mit der Präsentation auf der MODEX in Atlanta und der geplanten Eröffnung eines Büros in Boston in diesem Sommer bläst Sereact zum Angriff auf den US-Markt. Amerikanische Hersteller fordern produktreife KI, die sofort einsatzbereit ist.

Für die Gründer*innenszene sendet Sereact ein klares Signal: Der nächste Paradigmenwechsel der KI findet in der physischen Welt statt (Embodied AI). Der Erfolg in den USA wird davon abhängen, ob das Stuttgarter Daten-Flywheel auch gegen die gigantischen Budgets der US-Konkurrenz bestehen kann. Sereact hat den Grundstein gelegt, um das „Gehirn“ der globalen Automatisierung zu werden.

Vom Assekuradeur zum Cyber-Abwehrzentrum: Baobabs riskante Wette auf die All-in-One-Lösung

Es ist ein mutiger Schritt für ein junges Unternehmen: Das 2021 in Berlin gegründete InsurTech Baobab Insurance streift sein reines Versicherungs-Image ab und firmiert ab sofort unter dem Namen Baobab Risk Solutions (BRS). Zeitgleich führt das Start-up einen eigenen Managed Detection and Response (MDR) Service ein. Damit will das Unternehmen künftig nicht mehr nur den finanziellen Schaden bei Cyberangriffen abfedern, sondern die Angriffe selbst aktiv abwehren. Ein ambitionierter Plan, der das Geschäftsmodell unter enormen Leistungsdruck setzt.

„Unser neuer Name ist ein Versprechen an den Markt: Wir bieten keine bloßen Policen, sondern eine ganzheitliche Strategie gegen digitale Risiken“, erklärt Mitgründer und Geschäftsführer Vincenz Klemm. Prävention, Abwehr und Versicherung sollen fortan eine untrennbare Einheit bilden. Auf die Vermutung, das reine Versicherungsgeschäft sei für den Mittelstand schlichtweg zu unprofitabel geworden, kontert der Gründer deutlich: „Der Wechsel zu Risk Solutions ist weit mehr als ein neues Branding. Damit lösen wir unser Gründungsversprechen konsequent ein.“ Die bloße Police sei nie das Endprodukt gewesen, der Schritt zum aktiven Abwehrdienstleister sei von Tag eins an auf der Roadmap gestanden. Klemm fasst die neue Ausrichtung in einem klaren Kernsatz zusammen: „Wir warten somit nicht darauf, dass ein Schaden reguliert werden muss. Wir sorgen stattdessen aktiv dafür, dass er gar nicht erst entsteht.“ Dies sei kein Ausstieg aus der Versicherung, sondern die Evolution zum echten Risikomanagement für den Mittelstand und Industrieunternehmen.

Vom Millionen-Exit zum Cyber-Schutzschild

Um die Ambitionen von Baobab Risk Solutions zu verstehen, lohnt ein Blick auf das Gründer-Duo. Vincenz Klemm (Geschäftsführer) und Anton Foth (CTO) bringen geballte Erfahrung mit. Klemm baute in den USA den digitalen Makler Gabi auf und verkaufte ihn für rund 320 Millionen US-Dollar an Experian, während Foth als ehemaliger CTO von Coya (später Luko) die tiefe technische Expertise für datengetriebene Versicherungsmodelle liefert. Gestartet mit rund 4,2 Millionen US-Dollar Pre-Seed-Kapital, ist das Unternehmen mittlerweile in Deutschland, Österreich und den Benelux-Ländern aktiv.

Der Aufbau eines europäischen Assekuradeurs in den vergangenen fünf Jahren verlief dabei nicht ohne Hürden. „Eine europäische Expansion ist niemals eine reine Blaupause“, räumt Klemm ein. Um regulatorische Fallstricke frühzeitig zu erkennen, setze man gezielt auf lokale Expertise wie den General Manager für die Benelux-Staaten, Tim van Lier. Als größten Trumpf sieht Klemm jedoch die eigene Reaktionsgeschwindigkeit: „Wenn etwas nicht funktioniert, korrigieren wir es binnen Tagen, statt in monatelangen Release-Zyklen zu verharren.“ Auch die Frage nach frischem Kapital für den nun extrem kostenintensiven MDR-Betrieb wischt er routiniert beiseite: Man sei durch die letzte Finanzierungsrunde hervorragend aufgestellt. Sollte man dennoch nachlegen müssen, wisse man Investoren an der Seite, die „bei positiven Trends extrem schnell Kapital mobilisieren können.“

Der neue Vorstoß: MDR und ein 24/7-Defense-Center

Die Argumente für den neuen, zubuchbaren MDR-Service stützen sich auf drastische Marktveränderungen. Laut dem CrowdStrike Global Threat Report 2026 erfolgen 82 Prozent aller Angriffe mittlerweile ohne klassische Schadsoftware, woran Standard-Antivirus-Programme oft scheitern. Baobabs Antwort darauf ist ein rund um die Uhr besetztes Security Operations Center (SOC). Die Ansagen des Start-ups sind selbstbewusst: Mit einer Erkennungsrate von 99 Prozent identifiziere man Bedrohungen bereits in der Entstehungsphase. Die hauseigene Deep-Scan-Technologie arbeite 3,2-mal effektiver als herkömmliche Scans, zudem liege die Angriffsfrequenz bei Bestandskund*innen um 77 Prozent unter dem Marktdurchschnitt. Ergänzt wird das Ganze durch Dark Web Monitoring.

Doch wie kann ein Start-up im Angesicht des globalen Fachkräftemangels in der Cybersecurity personell und technologisch mit staatlich finanzierten Hacker-Syndikaten mithalten? Klemm verweist auf das ambitionierte Umfeld: Weil das Team Kunden aktiv berate und nicht nur stumpf Risiken überwache, habe man sich als Top-Adresse für Talente etabliert. Gleichzeitig gibt er sich pragmatisch und räumt ein, dass man nicht alles allein stemmen kann: „Um personelle Spitzen abzufangen, kooperieren wir mit hochprofessionellen Technologiepartnern.“ Diese Hybridstrategie sichere die Skalierbarkeit und den Zugang zu führender Technologie. Das absolute Kernversprechen an den Kunden tastet er dabei jedoch nicht an: „Die Analyse und der direkte Kontakt bleiben immer bei uns.“

Genial verzahnt oder überhoben?

In der Theorie ist die Verknüpfung von aktiver Abwehr und Versicherung genial: Versagen die Abwehrmaßnahmen von Baobab, muss die Versicherung den finanziellen Schaden ohnehin tragen – die Interessen von Kund*in und Versicherer sind maximal synchronisiert. In der Praxis gleicht der Betrieb eines 24/7-SOC jedoch einem Hochseilakt, der extrem personal- und kostenintensiv ist. Zudem droht ein massives Klumpenrisiko, falls ein neuartiger Zero-Day-Exploit die Filterlogik umgeht und hunderte Mittelständlerinnen gleichzeitig kompromittiert werden.

Auf dieses „All-Eggs-in-One-Basket“-Szenario angesprochen, reagiert Klemm unaufgeregt und verweist auf die harten Realitäten der Branche: „In der Cybersecurity gibt es keine hundertprozentige Sicherheit. Daher stellt ein neuartiger Zero-Day-Exploit für die gesamte Branche grundsätzlich ein Kumulrisiko dar.“ Doch genau dieses Risiko trage man als Assekuradeur über die Policen ohnehin bereits. Der MDR-Service sei kein zusätzliches Risiko, sondern ein Schutzschild. „Anstatt die Gefahr zu vergrößern, reduziert unsere aktive Abwehr die Wahrscheinlichkeit, dass ein solches Ereignis überhaupt zum Tragen kommt“, argumentiert der Geschäftsführer. Und wenn alle Stricke reißen? „Die Versicherungspolice ist der finale Sicherheitsanker für den reinen Risikotransfer“, stellt er klar.

Markt & Wettbewerb: Kampf der Titanen

Im Mid-Market-Segment tritt das Berliner Team gegen globale Giganten wie Munich Re oder spezialisierte Cyber-MGAs wie das US-Einhorn Coalition an. Auch der Markteintritt US-amerikanischer Riesen in Europa beunruhigt Klemm nicht – im Gegenteil: „Der Markteintritt globaler Akteure unterstreicht vor allem eines: Das enorme Potenzial des europäischen Cybermarktes.“

Die Marschroute für die kommenden 12 bis 18 Monate ist klar gesteckt. Man wolle die Verzahnung von Vorfallsreaktion (Incident Response) und MDR weiter vertiefen und die Schadenquote weiter unter den Marktdurchschnitt drücken. Der entscheidende Hebel soll jedoch die Radikalvereinfachung des Versicherungsabschlusses werden. „Unser Ziel: Der Abschluss einer Cyberversicherung oder Vertrauensschadenversicherung muss so einfach werden wie nie zuvor – für Makler und Kunden“, verspricht Klemm. Gegen die übermächtige Konkurrenz will er nicht durch schiere Finanzkraft gewinnen: „Wir gewinnen diesen Wettbewerb nicht über das größte Marketingbudget, sondern über das beste Risikomanagement und die engste Partnerschaft mit dem Mittelstand.“

Für die Branche ist Baobab damit ein spannendes Lehrstück über die Vertikalisierung von Geschäftsmodellen. Schaffen es die Berliner, ihr technologisches Versprechen zu halten, bauen sie eine hochprofitable Cybersecurity-Festung für den europäischen Mittelstand. Scheitert die Technik jedoch an der Realität komplexer Cyberbedrohungen, droht das gesamte Modell unter den eigenen Schadensquoten zu kollabieren. Es bleibt ein riskantes, aber zukunftsweisendes Play.

M&A im CleanTech-Sektor: SpotmyEnergy übernimmt Zählerhelden

Das 2023 von Jochen Schwill gegründete Kölner Start-up SpotmyEnergy übernimmt den kompletten Messstellenbetrieb des Mitbewerbers Zählerhelden und sichert sich damit rund 3.000 Smart Meter. Der Schritt markiert nicht nur anorganisches Wachstum, sondern verdeutlicht die beginnende Konsolidierung im deutschen Smart-Meter-Markt. Ein genauerer Blick auf die Macher, das Geschäftsmodell und einen Markt, der notorisch hinterherhinkt.

Hinter SpotmyEnergy steht mit Jochen Schwill ein prominenter Kopf der deutschen Energie-Start-up-szene. Schwill, bekannt als Gründer des virtuellen Kraftwerks Next Kraftwerke, rief das CleanTech-Startup im Jahr 2023 in Köln ins Leben. SpotmyEnergy agiert als unabhängiger, wettbewerblicher Messstellenbetreiber. Das Ziel des Unternehmens ist es, den in Deutschland stockenden Ausbau von intelligenten Messsystemen entscheidend zu beschleunigen.

Das Zuhause als virtuelles Kraftwerk

Das reine Aufhängen von Stromzählern ist in einem stark regulierten Markt kaum profitabel. SpotmyEnergy umgeht diese Falle durch einen ganzheitlichen Plattform-Ansatz:

- Hardware & Software: Das Startup liefert Lösungen zur Messung, Vernetzung, Optimierung und Steuerung von Photovoltaikanlagen, Wärmepumpen, Heimspeichern und Wallboxen.

- Drei-Säulen-Modell: Das Unternehmen fungiert als Messstellenbetreiber zur Bereitstellung von Smart Metern, als Energiemanager zur Kostenoptimierung der vernetzten Geräte und als Lieferant mit einem dynamischen Tarif, der Zugang zu aktuellen Börsenstrompreisen bietet.

- B2B2C-Vertrieb: Für den Rollout der Lösungen setzt SpotmyEnergy auf ein Partnernetzwerk, das seit der Firmengründung auf über 300 Elektroinstallationsbetriebe angewachsen ist.

Kritische Hinterfragung

Der Erfolg dieses Modells hängt maßgeblich von der fehlerfreien technischen Integration ab. SpotmyEnergy leistet aktuell Pionierarbeit bei der Einbindung von Steuerboxen, die in Deutschland bislang noch wenig verbreitet sind. Eine Übertragung derartiger Boxen in der aktuellen Größenordnung von 3.000 Stück hat es auf dem deutschen Markt bislang nicht gegeben. Die kritische Frage lautet: Funktionieren die technischen Schnittstellen dauerhaft und herstellerübergreifend reibungslos? Laut Geschäftsführer Schwill wurde mit der Etablierung der technischen Prozesse nun der Grundstein dafür gelegt, dass ein solcher Steuerboxwechsel in der Praxis überhaupt umsetzbar ist.

Markt & Wettbewerb

Deutschland ist beim Thema Smart Meter das Sorgenkind Europas; die Marktdurchdringung ist extrem gering. Dennoch drängen derzeit starke Wettbewerber*innen in die Nische, um sich die digitale Schnittstelle zum Kunden / zur Kundin für die Energiewende zu sichern:

- metrify: Die Enpal-Ausgründung ist mit über 65.000 installierten Systemen der Platzhirsch unter den wettbewerblichen Messstellenbetreibern.

- Inexogy & LichtBlick: Diese Anbieter kooperieren stark mit großen dynamischen Stromanbietern oder agieren als etablierte Ökostrom-Versorger mit eigenen Messstellen-Lösungen.

- Energy Metering Germany (Octopus Energy): Setzen auf gebündelte Angebote, oft gekoppelt an ihre eigenen intelligenten Tarife.

Unsere Einordnung

Die Übernahme des Zählerhelden-Portfolios ist ein strategischer Befreiungsschlag. Für die Kunden von Zählerhelden läuft der Betrieb laut Unternehmensangaben ohne Unterbrechung weiter, sie müssen keine eigenen Schritte einleiten. Die bisherigen Zählerhelden-Gesellschafter, ABM-Mess Service und BSH, konzentrieren sich künftig wieder stärker auf ihre jeweiligen Kerngeschäfte.

Ein hardwarebasiertes, stark reguliertes Geschäftsmodell erfordert extrem tiefe Taschen. SpotmyEnergy wird hierbei vom Investitions- und Strukturierungspartner Horizon Energy Deutschland flankiert, der das Start-up seit Ende des vergangenen Jahres bei der Skalierung unterstützt. Horizon stellt Kapital in Höhe von über 50 Millionen Euro für Smart-Meter-Assets zur Verfügung. Ein Teil dieser zugesicherten Mittel fließt nun direkt in die Übernahme der rund 3.000 Smart Meter von Zählerhelden. Genaue Angaben zum Kaufpreis oder den weiteren finanziellen Übernahmemodalitäten der Transaktion machen die beteiligten Unternehmen jedoch nicht. Wie Emil Bruusgaard, Geschäftsführer von Horizon Energy Deutschland, dennoch treffend analysiert, verdeutlicht die Transaktion anschaulich, wie sich fragmentierte Strukturen im Markt gezielt konsolidieren lassen, um die Grundlage für weiteres Wachstum zu schaffen.

Fazit

Jochen Schwill versucht mit SpotmyEnergy im Endkund*innenbereich das, was ihm im Industriebereich bereits gelang: die digitale Bündelung dezentraler Energieflüsse. Der Zukauf von Zählerhelden beweist eindrucksvoll, dass anorganisches Wachstum in dieser Branche ein essenzieller Hebel ist. Der wettbewerbliche Messstellenbetrieb bietet für ambitionierte Start-ups weiterhin enormes Entwicklungspotenzial.

BRYCK Startup Alliance: Vom Kohlenpott zum Code-Pott

Das Bundesministerium für Wirtschaft und Energie (BMWE) hat mit den exist Startup Factories ein hochambitioniertes Förderprogramm aufgesetzt. Das Ziel: Wissenschaftliche Erkenntnisse sollen schneller und skalierbarer in die Wirtschaft überführt werden. Eines der Leuchtturmprojekte entsteht derzeit im Ruhrgebiet. Wir werfen einen Blick auf den Status quo der BRYCK Startup Alliance, die Macher*innen im Hintergrund und die Frage, was das Konstrukt Gründenden in der Praxis wirklich bringt.

Deutschland habe ein Transferproblem, so die Analyse der Initiatoren. Während die heimischen Universitäten in der Grundlagenforschung weltweit Spitzengeschwindigkeiten fahren, gerate der Motor ins Stottern, sobald es darum gehe, aus diesen Erkenntnissen marktreife Unternehmen zu formen. Genau hier setzen die geförderten exist Startup Factories an. Sie haben den Auftrag, die Quantität und Qualität wissensbasierter Ausgründungen signifikant zu steigern.

Das Silicon Valley der Schwerindustrie?

Geführt wird die BRYCK Startup Alliance, die 2025 als einer der Sieger des exist-Wettbewerbs gekürt wurde, von einem fünfköpfigen Führungsteam um Geschäftsführer Philipp Herrmann. Herrmann, selbst Seriengründer und Investor, soll die Brücke zwischen akademischer Forschung und traditionellen Corporate-Strukturen schlagen. Das Ziel ist gewaltig: Das Ruhrgebiet soll sich zur führenden Modellregion für industrielle Erneuerung in Europa wandeln.

Warum aber ausgerechnet DeepTech und nicht etwa digitale B2B-Software, wo die Einstiegshürden niedriger wären? Herrmann stellt klar: „Weil wir hier nicht die x-te Region bauen sollten, die versucht, ein kleines Silicon Valley zu spielen.“ Das Ruhrgebiet habe andere Stärken, wie eine enorme Dichte an Hochschulen, Industrie und konkreten Anwendungsfeldern. Für ihn liegt die Zukunft Europas nicht in reinen Softwaremodellen, sondern in Feldern wie Energie, Wasserstoff oder industrieller Effizienz. „DeepTech hat für diese Region einen anderen Hebel“, betont er. Wenn hier etwas funktioniere, habe es echte Wirkung auf industrielle Prozesse und neue Wertschöpfung. Sein Fazit für die Region: „Nicht den schnellsten Hype, sondern den nachhaltigsten Umbau.“

Eine beispiellose Allianz – und potenzielle Corporate-Falle?

Das Fundament der Allianz ist massiv: Die Universitätsallianz Ruhr kooperiert mit der RAG-Stiftung und dem Initiativkreis Ruhr, einem Bündnis aus über 70 Konzernen wie E.ON oder RWE. Für Start-ups klinge das theoretisch nach einem Sechser im Lotto. In der Praxis jedoch drohen agile Gründer*innen oft in den bürokratischen Mühlen der Großkonzerne zu ersticken.

Herrmann räumt unumwunden ein: „Die Gefahr besteht absolut.“ Große Unternehmen seien nicht per se schnell, und Konzernprozesse könnten für junge Teams zermürbend sein. Die Allianz setze daher nicht auf bloßes Networking, sondern auf harte Vorsortierung. „Unser Job ist, viel stärker vorzusortieren: Wo gibt es ein echtes Problem? Wo gibt es auf Unternehmensseite jemanden, der das Thema wirklich treiben will?“ Ein echter „Fast Track“ sei am Ende immer ein gut vorbereiteter Prozess. Zwar werde dadurch nicht jede Reibung verschwinden, aber man könne die Wahrscheinlichkeit für erfolgreiche Pilotprojekte massiv erhöhen.

Status quo: Die Realitätsprüfung

Seit dem Start ist viel passiert: Weit über 130 Start-ups haben die Programme bereits durchlaufen. Zudem wurde mit „GF BRYCK Ventures“ ein 10-Millionen-Euro-Fonds für Frühphasen-Investments etabliert. Doch Herrmann gibt zu, dass zwischen Masterplan und Realität oft Welten liegen.

Besonders die Kluft zwischen Universität, Start-up und Konzern habe ihn in der täglichen Arbeit gefordert. Man habe gelernt, dass ein gutes Ökosystem neben einem „Nordstern“ vor allem „sehr viel operative Kleinarbeit an all den zu verändernden Schnittstellen“ benötige. DeepTech sei eben kein Sprint. „Das Ruhrgebiet verändert man auch nicht mit einer großen Überschrift“, so Herrmann. Vielmehr verändere man es Schritt für Schritt durch funktionierende Beispiele.

Der harte Weg aus dem Labor

Zwei der größten „Start-up-Killer“ bei Uni-Ausgründungen sind ungeklärte Patentrechte (IP) und einseitige Teams aus Forschenden ohne Vertriebserfahrung. Herrmann fordert hier bei den IP-Prozessen vor allem Geschwindigkeit und Verlässlichkeit. „Nichts ist schädlicher als Monate der Unklarheit.“

Gleichzeitig legt er den Fokus auf das Matching der Teams. Während die „Nerds“ aus dem Labor für die Technologie unverzichtbar seien, entstehe ein Unternehmen erst, wenn technologische Exzellenz und unternehmerische Kompetenz zusammenkommen. Er plädiert für ein neues Selbstverständnis: „Ich finde auch, wir müssen weg von diesem alten Denken, dass Forschung und Unternehmertum zwei getrennte Welten seien. Im Idealfall ist Unternehmertum der Weg, wie aus guter Forschung Wirkung wird.“

Was kostet die Förderung?

Mit dem neuen Fonds investiert die Allianz bis zu 300.000 Euro in der ganz frühen Phase. Pauschale Deal-Terms gebe es dabei bewusst nicht, da die Situationen der Teams zu unterschiedlich seien. Herrmann betont jedoch ein wichtiges Prinzip: „Frühphasenfinanzierung darf Gründer nicht klein, sondern muss sie handlungsfähig machen.“

Da 300.000 Euro bei DeepTech-Hardware oft nur ein Anfang sind, müsse man das „Valley of Death“ durch breitere Kapitalzugänge schließen. Er sieht hier eine große Aufgabe für ganz Europa: „Wir brauchen mehr geduldiges Kapital und bessere Anschlussfinanzierung für wissenschaftsbasierte Unternehmen.“ Ziel sei es, die Teams so aufzustellen, dass sie auch die nächste und übernächste Runde erreichen können.

Ausblick: Eine Milliarde fürs Ruhrgebiet

Bis 2030 sind die Ziele messbar: 1.000 wissenschaftsbasierte Ausgründungen und eine Milliarde Euro mobilisiertes Risikokapital. Ob das Projekt ein Erfolg wird, mache Herrmann an substanziellen Ergebnissen fest.

„Im Kern werden wir nur dann wirklich Strahl- und Magnetkraft auf europäischer Ebene entwickeln, wenn aus unseren Startups groß skalierte Unternehmen entstehen – wirkliche Unicorns, die Industrien verändern“, kontert er. Man müsse beweisen, dass hier Firmen entstehen, die industrielle Probleme auf Weltklasseniveau lösen. Sein Wunsch für die nächsten vier Jahre: „Dass das kein spannendes Einzelprojekt mehr ist, sondern ein funktionierendes System mit echter Zugkraft.“ Wenn die ersten Teams aus diesem System zu echten Erfolgsgeschichten werden, sei das der stärkste Beleg für den Erfolg.

Factsheet: BRYCK Startup Alliance auf einen Blick

- Offizieller Name: BRYCK Startup Alliance

- Fokus: DeepTech, B2B, industrielle Transformation

- Status: Prämierte exist Startup Factory des BMWE (Entscheidung am 10. Juli 2025)

- Geschäftsführung: Philipp Herrmann, Dr. Christian Lüdtke, Philippa Köhnk, Ersin Üstün, Maximilian Weil-Schimanski

- Wissenschaftliches Rückgrat: Universitätsallianz Ruhr (Bochum, Dortmund, Duisburg-Essen)

- Wirtschaftliches Netzwerk: Initiativkreis Ruhr (über 70 Top-Unternehmen) & RAG-Stiftung

- Finanzierung: GF BRYCK Ventures (10 Mio. Euro Fonds, Tickets bis zu 300.000 Euro)

- Ziele bis 2030: 1.000 Ausgründungen, 200 skalierende DeepTech-Start-ups, 1 Mrd. Euro mobilisiertes Kapital

- Website: bryckstartupalliance.com/de

Schluss mit Kaskodenken: Was der neue Innovationsrat Gründer*innen bringt

Pünktlich zur Hannover Messe formiert sich ein neues Schwergewicht in der deutschen Technologiepolitik: Acht Expertinnen und Experten haben den ehrenamtlichen „Innovationsrat für Deutschland“ ins Leben gerufen. Getragen von der VDI-Initiative „Zukunft Deutschland 2050“ und der Gesellschaft für Informatik (GI) bündelt das Gremium die Stimmen von über 160.000 Ingenieur*innen und Informatiker*innen.

Die Diagnose des Rats fällt drastisch aus: Deutschland verliere im globalen Wettbewerb an Verbindlichkeit und Umsetzungsgeschwindigkeit. Für die Gründer*ionnenszene birgt das Manifest vielversprechende Forderungen – es stellt sich jedoch auch die Frage, ob ein weiteres Gremium die strukturelle Risikoaversion des Standorts durchbrechen kann.

Das Kernproblem: Erfunden in Deutschland, skaliert im Ausland?

Das zentrale Narrativ des Innovationsrats trifft einen wunden Punkt der heimischen Start-up-Ökonomie: Es dürfe nicht länger passieren, dass Schlüsseltechnologien zwar in deutschen Forschungslaboren erfunden, aber aufgrund fehlenden Kapitals oder restriktiver Regulierung im Ausland skaliert werden. Der Rat fordert in seinen „5 Impulsen“ eine fundamentale Neuausrichtung:

- Schluss mit dem Legislaturperioden-Takt: Innovationspolitik muss langfristig und faktenbasiert gedacht werden, nicht in kurzatmigen Wahlzyklen.

- Regulierung als Enabler statt als Bremse: Die Expert*innen fordern den Abbau von europäischem „Goldplating“ (der innovationsfeindlichen Übererfüllung von EU-Normen durch nationale Gesetze) und die Schaffung echter Experimentierräume und Reallabore.

- Mut statt „Kaskodenken“: Anstatt risikoscheu zu agieren, müssen strategische Investitionen in Schlüsseltechnologien fließen. Die Rahmenbedingungen für Scale-ups müssen massiv verbessert werden, um industrielles Skalieren im eigenen Land zu ermöglichen.

Die Köpfe hinter dem Innovationsrat für Deutschland

Die Zusammensetzung des Gremiums unterstreicht den Anspruch, Technologie, Recht und Wirtschaft zusammenzudenken:

- Prof. Dr. Lutz Eckstein: VDI-Präsident und Experte für automatisiertes Fahren an der RWTH Aachen.

- Prof. Dr. Veronika Grimm: Professorin an der TU Nürnberg und als „Wirtschaftsweise“ eine der prägendsten Stimmen der Energiepolitik.

- Prof. Dietmar Harhoff, PhD: Direktor am Max-Planck-Institut für Innovation und Wettbewerb sowie langjähriger EFI-Vorsitzender.

- Prof. Dr. Jürgen Kühling: Regulierungs- und Wettbewerbsexperte sowie ehemaliger Vorsitzender der Monopolkommission.

- Dr. Anne Lamp: Gründerin und Pionierin im Bereich Circular Economy.

- Dr. Melanie Maas-Brunner: Industrielle Forschungsexpertin, ehemalige BASF-Vorständin und designierte Präsidentin des Stifterverbands.

- Adrian Willig: Direktor des VDI mit Fokus auf Ingenieurkompetenzen und Technikstandort-Förderung.

- Prof. Dr. Martin Wolf: Präsident der Gesellschaft für Informatik und Experte für intelligente Produktionssysteme.

Im Start-up-Fokus: Dr. Anne Lamp und der harte Weg der Skalierung

Dass der Innovationsrat nicht nur aus der wissenschaftlichen Helikopterperspektive agiert, zeigt eine entscheidende Personalie: Dr. Anne Lamp sitzt am Tisch. Die CEO und Mitgründerin des Hamburger Start-ups traceless materials steht wie kaum eine andere für die Herausforderungen der industriellen Kreislaufwirtschaft.

Im Jahr 2020 ins Leben gerufen, hat traceless ein vollständig biobasiertes Granulat aus Agrar-Reststoffen entwickelt, das als Alternative zu Plastik dient und unter natürlichen Bedingungen in nur zwei bis neun Wochen kompostierbar ist. Lamp, 2022 mit dem Deutschen Gründerpreis ausgezeichnet und 2025 für den Deutschen Zukunftspreis nominiert, hat ihr Unternehmen erfolgreich aus dem Labor geholt. Mit der Realisierung einer groß angelegten Demonstrationsanlage hat das Start-up das für Hardware-Gründungen berüchtigte „Tal des Todes“ gemeistert. Mit der geplanten Industrieanlage soll die Kapazität künftig um ein Vielfaches gesteigert und das Material massentauglich gemacht werden. Lamps Vita verkörpert exakt das, was der Rat nun auf politischer Ebene einfordert: Die erfolgreiche Überführung nachhaltiger Technologien von der Erfindung in die marktfähige, industrielle Skalierung.

Unsere Einordnung: Ein weiteres Gremium oder echter Hebel?

Die entscheidende Frage für Gründer*innen und Start-ups bleibt: Bewirkt dieser Rat wirklich etwas? An technologiepolitischen Beiräten mangelt es der Bundesrepublik traditionell nicht. So sitzt mit Prof. Dietmar Harhoff bezeichnenderweise der langjährige Vorsitzende der bereits existierenden Expertenkommission Forschung und Innovation (EFI) der Bundesregierung ebenfalls in diesem neuen Gremium.

Dennoch hat der Innovationsrat zwei strategische Vorteile: Er ist explizit unabhängig von Parteien und Einzelinteressen der Wirtschaft und vereint mit dem VDI und der GI die geballte Umsetzungskompetenz der technischen Basis. Die Visionen sind ambitioniert – etwa die Forderung, vertrauenswürdige KI als „Trained in Germany“ zu einem neuen globalen Gütesiegel aufzubauen.

Für Deep-Tech- und Hardware-Start-ups wird der Rat jedoch nicht an der bloßen Anzahl seiner künftigen Stellungnahmen gemessen werden, sondern daran, ob seine Impulse tatsächlich in den Maschinenraum der Politik vordringen. Erst wenn das geforderte Kapital für die Wachstumsphase fließt und Genehmigungsverfahren radikal entschlackt werden, wird das „Kaskodenken“ wirklich der Vergangenheit angehören.

Synera sichert sich 35 Mio. Euro für die Revolution des Engineerings

Was einst als bionisches Forschungsprojekt begann, ist heute eine der vielversprechendsten europäischen DeepTech-Hoffnungen. Doch wie tragfähig ist die Vision vom „autonomen digitalen Ingenieur“ im stark regulierten Maschinenbau? Ein tieferer Blick auf Gründer, Markt und das Geschäftsmodell.

Die deutsche Industrie steht unter massivem Druck: Internationale Konkurrenz – insbesondere aus Asien –, chronischer Fachkräftemangel und die Notwendigkeit, Entwicklungszyklen drastisch zu verkürzen, zwingen zum Handeln. Generative künstliche Intelligenz (GenAI) gilt als Heilsbringer, doch in der Praxis verpuffen viele Initiativen. Nur etwa 41 Prozent der KI-Prototypen in der Fertigungsindustrie erreichen laut Branchenstudien den produktiven Einsatz. Die Konstruktions- und Entwicklungsabteilungen gelten als stark in Silos organisiert und bis heute schwer automatisierbar.

„Engineering ist das Rückgrat jedes Industrieunternehmens, gehört jedoch nach wie vor zu den am wenigsten digitalisierten und automatisierten Funktionen und war bis vor Kurzem für KI weitgehend unzugänglich“, bringt es Dr. Moritz Maier, Co-CEO von Synera, auf den Punkt.

Genau in diese Lücke stößt sein Unternehmen. Mit einer Series-B-Finanzierungsrunde über 35 Millionen Euro will das Bremer Startup nun international skalieren. Angeführt wird die Runde vom europäischen Wachstumsfonds Revaia, mit starker Beteiligung des UVC Partners Wachstumsfonds sowie Capgemini (über ISAI Cap Ventures). Auch die Bestandsinvestoren Spark Capital, BMW iVentures und Cherry Ventures ziehen wieder mit. Das Signal an den Markt ist deutlich: Engineering Automation wird zum nächsten großen Software-Schlachtfeld.

Von Kieselalgen zur KI-Plattform

Hinter Synera stehen die Gründer Moritz Maier, Daniel Siegel (beide Co-CEO) und Sebastian Möller (Managing Director). Die Ursprungsidee entstand am renommierten Alfred-Wegener-Institut (AWI) in Bremerhaven. Die Gründer forschten dort im Bereich der Bionik und untersuchten die Leichtbaustrukturen von Kieselalgen, um deren evolutionäre Prinzipien auf technische Bauteile zu übertragen.

Aus „Evolutionary Light Structure Engineering“ wurde 2018 die Ausgründung ELISE. Zunächst lag der Fokus auf algorithmusbasiertem Design. Mit der Zeit erkannten die Gründer jedoch ein viel grundlegenderes Problem: Es fehlte nicht an Software für das eigentliche Design, sondern an einer Brücke, die die unzähligen Insellösungen (CAD, Simulation, Materialprüfung) im Engineering-Alltag verbindet. Dies führte zur Neuausrichtung und schließlich zur Umbenennung in Synera – einer Low-Code- und KI-Plattform für Connected Engineering.

Das Geschäftsmodell im Check

Synera betreibt ein klassisches B2B-Plattform-Modell. Anstatt etablierte Platzhirsche im Computer-Aided Design (CAD) zu verdrängen, positioniert sich Synera als übergeordnete Orchestrierungsschicht. Die Software klinkt sich in über 80 bestehende Tools ein.

- Der Werttreiber: Nutzer*innen können komplexe Workflows (z. B. CAD-Modellierung → Simulation → Kostenkalkulation → Designanpassung) als Templates speichern. Das frische Kapital soll laut Moritz Maier nun eine Entwicklung beschleunigen, „bei der KI-Agenten als echte digitale Engineers agieren und komplexe Workflows entlang der gesamten Wertschöpfungskette autonom ausführen.“

- Der Lock-in-Effekt: Wenn ein Industriekonzern seine Kernprozesse auf Synera automatisiert hat, ist die Plattform kaum noch auszutauschen. Die Wechselkosten für den Kunden sind enorm.

- Die Herausforderungen: Das Modell ist technisch hochkomplex. Die ständige Pflege von über 80 API-Schnittstellen zu Drittanbietern bindet gewaltige Entwickler*innen-Ressourcen. Zudem erfordert der Vertrieb in klassische Hardware-Unternehmen lange Sales-Zyklen.

Zwischen RPA und Spezial-CAD

Wettbewerbsumfeld | Marktansatz | Syneras Differenzierung |

Generatives Design (z. B. nTop, Altair) | Fokus auf die Erstellung hochkomplexer, gewichtsoptimierter Bauteile. | Synera generiert nicht nur das Design, sondern automatisiert den Prozess quer durch verschiedene externe Tools. |

Klassische RPA (z. B. UiPath, Zapier) | Hervorragend für kaufmännische Prozesse (HR, CRM, Rechnungen). | Standard-RPA scheitert an den komplexen 3D-Geometrie- und Physikdaten des Engineerings. |

PLM-Systeme (z. B. Siemens, Dassault) | Verwalten den gesamten Produktlebenszyklus und die Daten. | Synera setzt sich auf diese oft schwerfälligen Systeme, um die agilen Arbeitsschritte flexibler zu machen. |

Kritische Einordnung: Vertraut der/die Ingenieur*in der KI?

Synera verweist auf eine Umsatzverdopplung im vergangenen Jahr und über 60 namhafte Kunden, darunter BMW, Airbus, NASA und Miele. Mit dem frischen Kapital steht die Expansion nach Asien, Europa und in die USA an. Dass dieser Wachstumskurs von den Investoren aktiv gestützt wird, betont Benjamin Erhart, General Partner bei UVC Partners: „Wir konnten erleben, wie Synera als zuverlässiger Partner die Transformation des Engineerings gestaltet.“

Doch der Weg zur breiten Durchdringung birgt auch Stolpersteine:

- Das Vertrauensproblem: „Agentic AI“ bedeutet, dass die Software eigenständig Entscheidungen trifft. In sicherheitskritischen Branchen (Luftfahrt, Automotive) herrschen jedoch strikte Compliance-Regeln. Bevor ein KI-Agent autonome Designänderungen an tragenden Bauteilen vornimmt, müssen massive Haftungsfragen geklärt sein.

- Die Pilot-Falle: Viele GenAI-Projekte scheitern auf dem Weg in die Produktion. Die Gefahr für Synera besteht darin, in Innovationsabteilungen stecken zu bleiben, während das operative Kerngeschäft aus Kostengründen an bewährten Methoden festhält.

- Die API-Abhängigkeit: Wer als Brückenbauer*in zwischen Dutzenden Software-Silos agiert, macht sich von den Anbietern abhängig. Sperrt ein großer CAD-Anbieter seine API, trifft dies Syneras Modell im Kern.

Fazit

Synera ist ein exzellentes Beispiel dafür, wie aus akademischer Grundlagenforschung ein hoch skalierbares DeepTech-Produkt werden kann. Der strategische Pivot vom reinen Design-Tool zur prozessübergreifenden Plattform zahlt sich durch die starke Series B nun aus. Gelingt es den Bremern, den eher konservativen globalen Maschinenbau davon zu überzeugen, dass KI-Agenten die menschlichen Ingenieur*innen nicht ersetzen, sondern befähigen, könnte Synera der entscheidende globale Standard im Connected Engineering werden.

Strategischer Exit: food42morrow übergibt seine Getränkemarke JUMA an die Berentzen-Gruppe

Die Konsolidierung im Markt für funktionale Getränke setzt sich fort: die 2022 gegründete food42morrow GmbH übergibt ihre Marke JUMA im Rahmen eines strategischen Exits an die Vivaris Getränke GmbH & Co. KG, eine Tochtergesellschaft der börsennotierten Berentzen-Gruppe Aktiengesellschaft. Ab Mai 2026 soll die großflächige Skalierung unter der Flagge von Vivaris als JUMA Recharge+ erfolgen.

Die food42morrow GmbH wurde 2022 in Frankfurt am Main mit dem Ziel gegründet, Marktlücken im Bereich Functional Food durch wissenschaftlich fundierte und trendorientierte Konzepte zu schließen. Die Gründer Raoul Kammann, Max Kammann und Carlos Lopez Granado entwickelten mit JUMA eine Antwort auf die steigende Nachfrage nach natürlichen Wachmachern.

Das Kernprodukt RECHARGE+ ist ein teebasierter Hydration Drink, der Elektrolyte, Vitamine und natürliches Koffein (u. a. aus Guayusa) kombiniert. Der Fokus liegt hierbei auf einer Funktionalität ohne Zuckerzusatz, die speziell auf die Bedürfnisse einer urbanen, aktiven Zielgruppe zugeschnitten ist. Bereits 2025 konnte das Start-up die Marktfähigkeit durch erste Listungen im deutschen Lebensmitteleinzelhandel (LEH) nachweisen.

Packaging-Innovation als strategischer Hebel

Ein wesentliches Alleinstellungsmerkmal, das den Exit maßgeblich begünstigt haben dürfte, ist das innovative Gebinde. food42morrow brachte als erstes Unternehmen in Deutschland eine wiederverschließbare Aluminiumflasche mit Schraubverschluss in dieser Kategorie auf den Markt. Diese Verpackung kombiniert die hohe Recyclingquote von Aluminium mit der Flexibilität einer Flasche. Für etablierte Konzerne wie die Berentzen-Gruppe stellt eine solche bereits validierte „Hardware-Innovation“ einen hohen Wert dar, da sie das Risiko bei der Markteinführung neuer Kategorien senkt.

Einordnung: Die „Evolve 2030“-Strategie

Der Zukauf durch die Berentzen-Gruppe ist kein Zufall, sondern Teil einer breiteren Branchenbewegung. Mit der Strategie BERENTZEN EVOLVE 2030 reagiert der Konzern auf den rückläufigen Spirituosenkonsum und investiert massiv in das Segment der alkoholfreien Getränke (AfG). JUMA fungiert hierbei als Portfolio-Ergänzung im margenstarken Premium-Bereich der funktionalen Drinks. Ähnliche Strategien verfolgten zuletzt auch Akteure wie Eckes-Granini oder die Paulaner-Gruppe bei der Integration agiler Innovationsmarken.

Key Learnings für Gründer*innen

Aus dem Case food42morrow lassen sich drei zentrale Erkenntnisse für die Skalierung von Konsumgüter-Start-ups ableiten:

- USP durch Packaging: In einem gesättigten Markt reicht ein guter Inhalt oft nicht aus. Eine technologische oder funktionale Innovation bei der Verpackung kann der entscheidende Türöffner für den LEH und für Akquisitionsgespräche sein.

- Validierung vor Skalierung: Der Exit erfolgte erst, nachdem die Marktfähigkeit (Proof of Market) durch erste Listungen 2025 bewiesen war. Große Player kaufen bevorzugt Marken, die ihre „Kinderkrankheiten“ bereits überwunden haben.

- Positionierung als „Brückenbauer“: food42morrow hat sich erfolgreich als Bindeglied zwischen Start-up-Agilität und industrieller Skalierung positioniert. Dies ermöglicht es den Gründern, sich auf ihre Kernkompetenz – die Produktentwicklung – zu konzentrieren, während die massive Distribution durch die Strukturen eines Konzerns erfolgt.

Was kommt nach JUMA?

Mit der Übergabe der Marke an Vivaris stellt food42morrow seine Kompetenz als Innovationstaktgeber unter Beweis. Bleibt die spannende Frage, welche Trends das Frankfurter Team als Nächstes identifiziert.

50 Mio. US-Dollar-Series A-Runde für Berliner FinTech Midas

Das 2024 von Dennis Dinkelmeyer, Fabrice Grinda und Romain Bourgois gegründete Web3-Start-up Midas sammelt 50 Mio. $ ein, um tokenisierte Vermögenswerte sofort liquide zu machen. Das frische Kapital soll primär in die Entwicklung und Skalierung der sogenannten Midas Staked Liquidity (MSL) fließen.

Der Markt für tokenisierte Vermögenswerte (Real World Assets, kurz RWA) wächst rasant, leidet jedoch noch immer an einer strukturellen Hürde: Während Kryptomärkte rund um die Uhr in Echtzeit handeln, sind traditionelle Finanzprodukte im Hintergrund oft an klassische, mehrtägige Abwicklungszyklen gebunden. Wenn Investor*innen ihre Token in liquide Mittel zurücktauschen wollen, kommt es unweigerlich zu Verzögerungen. Genau diese Lücke will das Berliner FinTech Midas nun schließen und hat dafür massiv Kapital aufgenommen.

Wie das Unternehmen heute mitteilte, flossen in einer Series-A-Finanzierungsrunde 50 Millionen US-Dollar (rund 46 Millionen Euro). Angeführt wird die Runde von den Venture-Capital-Firmen RRE Ventures und Creandum. Zu den weiteren Geldgebern zählen namhafte Branchengrößen wie Framework Ventures, Coinbase Ventures sowie der traditionelle Vermögensverwalter Franklin Templeton, der selbst bereits stark im Bereich tokenisierter Anlageprodukte aktiv ist. Mit der aktuellen Runde steigt das Gesamtfinanzierungsvolumen des Start-ups auf knapp 59 Millionen US-Dollar.

Das Gründerteam aus TradFi und Web3

Hinter Midas, das 2024 gegründet wurde, steht ein Team, das tiefes Wissen aus der traditionellen Finanzwelt (TradFi), dem Venture Capital und dem dezentralen Finanzsektor (DeFi) vereint. An der Spitze steht CEO und Mitgründer Dennis Dinkelmeyer, der vor der Gründung im Investment Research bei Branchengrößen wie Goldman Sachs und der Capital Group tätig war. Er bringt das essenzielle Verständnis für die Strukturierung institutioneller Anlageprodukte in die Blockchain-Welt ein.

Ergänzt wird die Führungsriege durch Executive Chairman und Mitgründer Fabrice Grinda. Als Gründungspartner des Investmentfonds FJ Labs gehört Grinda zu den weltweit aktivsten Angel-Investoren. Er steuert neben Kapital und einem enormen Netzwerk auch operative Erfahrung bei, die er unter anderem als Co-Gründer der für über eine Milliarde US-Dollar übernommenen Plattform OLX sammelte. Komplettiert wird das Führungstrio von Mitgründer Romain Bourgois. Der Tech-Experte war fast ein Jahrzehnt in leitenden Produktrollen beim AdTech-Giganten Criteo tätig, bevor er als Head of Product zum US-Konkurrenten Ondo Finance wechselte. Dort leistete er maßgebliche Pionierarbeit bei der Entwicklung und Skalierung der ersten großen tokenisierten US-Staatsanleihen, wie etwa OUSG und USDY.

Fokus auf „Midas Staked Liquidity“ (MSL)

Das frische Kapital soll primär in die Entwicklung und Skalierung der sogenannten Midas Staked Liquidity (MSL) fließen. Dabei handelt es sich um einen dedizierten Liquiditätspuffer, gegen den die firmeneigenen Token (mToken) jederzeit und ohne Wartezeit eingelöst werden können. Für institutionelle Investoren, die Treasury- und Portfolio-Management auf der Blockchain betreiben, ist diese sofortige Liquidität ein entscheidendes Kriterium.

Bisher mussten Rendite-Investoren oft zwischen der sofortigen Handelbarkeit und den Erträgen von DeFi-Protokollen abwägen – MSL soll diesen Kompromiss überflüssig machen. Die Midas-Plattform überführt dafür institutionelle Anlagestrategien, wie etwa Staatsanleihen (mTBILL) oder Basis-Handelsstrategien (mBASIS), in regulierungskonforme Token, die nahtlos in DeFi-Netzwerke wie Morpho oder Pendle integriert werden können. Nach eigenen Angaben hat Midas seit dem Start Token im Gesamtwert von über 1,7 Milliarden US-Dollar emittiert und dabei Erträge in Höhe von 37 Millionen US-Dollar an seine mehr als 20.000 Nutzer ausgeschüttet. Das Fintech finanziert sich dabei über Gebühren, die auf diese erwirtschafteten Renditen erhoben werden.

Die Brücke zwischen Wall Street und Blockchain

„Wir arbeiten auf eine Zukunft hin, in der Investitionen wie das Internet funktionieren: offen, transparent, kombinierbar und standardmäßig zugänglich“, formuliert CEO Dennis Dinkelmeyer den Anspruch des Unternehmens. Vic Singh, General Partner bei RRE Ventures, teilt diese Vision: Die Tokenisierung werde die globalen Kapitalmärkte fundamental verändern, sobald die traditionelle Finanzwelt ihre Infrastruktur vollständig auf die Blockchain verlagere.

Neben der Etablierung von MSL plant Midas, das frische Kapital für die Erschließung weiterer Anlageklassen und den Ausbau von Partnerschaften zu nutzen. Mit dem Einstieg von Schwergewichten wie Franklin Templeton und Coinbase Ventures positioniert sich das 2024 gegründete Unternehmen damit als einer der zentralen Infrastrukturanbieter an der lukrativen Schnittstelle zwischen klassischem Finanzwesen und der Krypto-Ökonomie.

Griff nach den Sternen: Lieferando- und Tier-Mitgründer sammelt 5 Mio. Euro für Solarenergie aus dem All

Das europäische Start-up TerraSpark will sauberen Strom per Funk aus dem Orbit zur Erde schicken. Mit dabei: der Deutsche Matthias Laug, Mitgründer von Lieferando und Tier Mobility, sowie deutsche Investoren. Wir wollten wissen: Wie realistisch ist das ehrgeizige Vorhaben der Tech- und Raumfahrt-Veteranen? Eine Einordnung.

Europas Energieinfrastruktur stößt zunehmend an ihre Grenzen. Während die Internationale Energieagentur (IEA) prognostiziert, dass sich der Strombedarf von Rechenzentren bis 2030 mehr als verdoppeln wird, zeigten großflächige Stromausfälle in Spanien und Portugal zuletzt die Schwächen der heutigen Energiesysteme auf.

Eine radikale Lösung für dieses drängende Problem verspricht nun das 2025 in Luxemburg gegründete Start-up TerraSpark. Das junge Unternehmen hat eine Pre-Seed-Finanzierungsrunde in Höhe von über fünf Millionen Euro erfolgreich abgeschlossen. Zu den Geldgebern zählen neben der Pariser Gesellschaft Daphni und dem Tech-Investor Sake Bosch auch die Angel-Investoren-Allianz better ventures und die Hans(wo)men Group. Ihr gemeinsames Ziel: Weltraumgestützte Solarenergie kommerziell nutzbar zu machen.

Prominente deutsche Wurzeln in einem hochkomplexen Hardware-Projekt

Dass dieses Vorhaben für die hiesige Gründerszene von besonderem Interesse ist, liegt maßgeblich an der personellen Aufstellung. Hinter TerraSpark steht ein Gründertrio, das eine seltene Kombination aus europäischer Raumfahrtexpertise und massiver Skalierungserfahrung vereint. Aus deutscher Sicht sticht hierbei besonders Chief Operating Officer Matthias Laug hervor. Als Mitgründer von Lieferando und Tier Mobility bringt er tiefe Erfahrung im Aufbau und in der Skalierung großer europäischer Plattformunternehmen in das komplexe Projekt ein.

Geführt wird das Team von CEO Jasper Deprez, einem Seriengründer, der zuvor die globale HR-Tech-Plattform Tradler aufbaute. Die zwingend notwendige Raumfahrt-Expertise liefert Chief Technology Officer Dr. Sanjay Vijendran: Er verantwortete bei der Europäischen Weltraumorganisation (ESA) bereits das Solaris-Programm zur weltraumgestützten Solarenergie und war an der Mars Sample Return Mission beteiligt. Auch auf Investor*innenseite ist das deutsche Vertrauen in das Team groß. Tina Dreimann, Gründerin und Geschäftsführerin von better ventures, lobt genau diese Mischung aus europäischer Raumfahrtkompetenz und der Erfahrung, Technologie wirklich zu skalieren.

Erst die Erde, dann das All

Die Vision des Trios ist gewaltig: Solarenergie soll im Weltraum eingefangen und per Funkfrequenz sicher zur Erde übertragen werden. Das Konzept ist in der Theorie bereits seit den 1970er Jahren bekannt, doch erst heute machen sinkende Startkosten sowie technologische Fortschritte in der Satellitenfertigung und Orbitrobotik die Umsetzung wirtschaftlich tragfähig.

Anstatt jedoch das immense Risiko einzugehen und sofort mit gigantischen Systemen im All zu beginnen, wählt TerraSpark bewusst einen schrittweisen Kommerzialisierungs-Ansatz. Das Startup startet auf der Erde mit der Kommerzialisierung funkfrequenzbasierter drahtloser Energieübertragung für industrielle Anwendungsfälle. Mit diesem pragmatischen Schritt sollen Sicherheit, Effizienz und regulatorische Kompatibilität im kleinen Maßstab demonstriert werden, bevor das System in den Orbit skaliert wird. Ein hochrelevanter Markt für diese erste Phase sind netzferne Regionen, die bislang auf Dieselgeneratoren angewiesen sind. Dort liegen die Stromkosten häufig bei etwa 0,70 bis 1,50 Euro pro Kilowattstunde – ein starkes Preissignal, das technologische Alternativen rasch wirtschaftlich attraktiv machen kann.

Um diesen Markt zu erschließen, bereitet das Unternehmen in den kommenden Monaten erste Pilotanwendungen vor, darunter die drahtlose Energieversorgung eines Live-Events. Auch die Roadmap für den Weg ins All steht: Ein erster orbitaler Technologie-Demonstrator ist für das Jahr 2027 geplant, die erste echte Weltraum-zu-Erde-Energieübertragung wird für 2028 anvisiert.

Markt, Wettbewerb & Machbarkeit

Obwohl die Physik hinter der funkfrequenzbasierten Energieübertragung laut CTO Sanjay Vijendran seit Jahrzehnten validiert ist, bleibt die weltraumgestützte Solarenergie ein extrem komplexes Unterfangen. TerraSpark ist auf diesem kapitalintensiven Spielfeld nicht allein. Neben Start-ups wie Virtus Solis aus den USA oder dem neuseeländisch-deutschen Unternehmen Emrod haben auch etablierte Luft- und Raumfahrtgiganten wie Airbus das enorme wirtschaftliche Potenzial längst erkannt und treiben eigene Forschungsprogramme voran.

Kritisch zu hinterfragen bleibt bei all diesen Vorhaben die technische Effizienz der Energieübertragung über gewaltige Distanzen bis hinunter zur Erde. Die Errichtung großflächiger Solarpaneele im Weltall erfordert trotz signifikant sinkender Frachtpreise weiterhin immense Vorabinvestitionen und unzählige Raketenstarts. Zudem muss der internationale regulatorische Rahmen für das Richten von hochkonzentrierten Funkwellen aus dem All auf irdische Empfangsstationen erst noch global abgestimmt werden.

Fazit

Der „Earth-first“-Ansatz von TerraSpark ist ein äußerst kluger, unternehmerischer Schachzug. Er mildert das finanzielle Risiko für die Seed-Investoren ab, demonstriert Technologie greifbar im Kleinen und könnte frühe B2B-Umsätze generieren, lange bevor die erste Hardware ins All fliegt. Dennoch bleibt der Meilenstein-Plan enorm ambitioniert. Matthias Laug und seine Mitstreiter*innen haben in der Vergangenheit zwar eindrucksvoll bewiesen, dass sie digitale und urbane Geschäftsmodelle massiv skalieren können. Der Schritt vom E-Scooter-Verleih zur interplanetaren Energie-Infrastruktur erfordert in den kommenden Jahren jedoch eine völlig neue Dimension der Exekution – und noch deutlich tiefere Taschen der Investor*innen.

Mediennutzung 2026: Zwischen KI-Frust, Abo-Müdigkeit und neuen Chancen für Start-ups

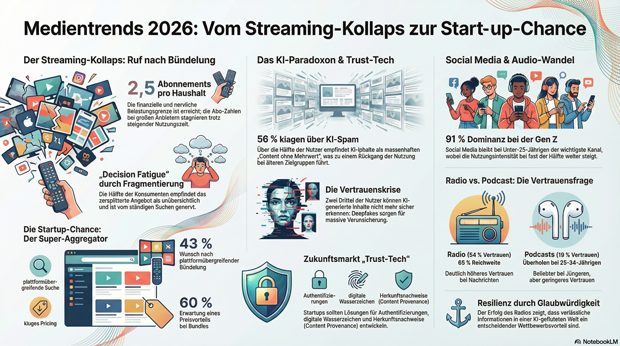

Die Deutschen experimentieren so intensiv wie nie mit künstlicher Intelligenz (KI), sind aber zunehmend genervt von Deepfakes und „Content ohne Mehrwert“. Gleichzeitig sehnt sich der überhitzte Streaming-Markt nach einer drastischen Konsolidierung. Die aktuelle Deloitte-Studie „Media Consumer Trends 2026“ liefert nicht nur Bestandsaufnahmen, sondern zeigt deutlich, wo für Gründer*innen und Tech-Unternehmen jetzt die wahren Opportunitäten liegen.

Social Media bleibt der unangefochtene Platzhirsch der Medienlandschaft: 78 Prozent der Konsument*innen in Deutschland sind auf den Plattformen aktiv, bei der Gen Z (unter 25 Jahre) sind es sogar satte 91 Prozent. Fast die Hälfte dieser jungen Zielgruppe nutzt Instagram, TikTok und Co. heute intensiver als noch im Vorjahr. Doch ein Blick unter die Oberfläche offenbart Risse im digitalen Fundament – und die haben maßgeblich mit dem rasanten Einzug generativer künstlicher Intelligenz (KI) zu tun.

Das KI-Paradoxon: Große Kreationslust, massives Vertrauensproblem

Auf der Creator-Seite ist KI bereits Alltag. 22 Prozent der Befragten haben laut Deloitte schon Bilder per KI erstellt, jeder Zehnte generiert Videos oder Musik. Auch die Zahlungsbereitschaft ist überraschend hoch: Jeder Fünfte wäre bereit, monatlich über 10 Euro für entsprechende Tools auszugeben.

Auf der Konsument*innenseite jedoch kippt die Stimmung bedenklich. Zwei Drittel der Nutzer*innen geben an, dass sie KI-generierte Inhalte im Netz nicht mehr zuverlässig erkennen können. Schlimmer noch: 56 Prozent klagen über eine wachsende Flut an KI-generierten Postings „ohne Mehrwert“ – schlichtweg digitaler Spam. Die Konsequenz dieser Verunsicherung zeigt sich bereits in den Nutzungsdaten: Erste Altersgruppen, insbesondere Nutzer*innen ab Mitte 50, beginnen, ihren Social-Media-Konsum aktiv zurückzufahren.

Die Start-up-Perspektive: Die Zeiten des blinden KI-Hypes sind vorbei. Wer als Gründer*in heute rein quantitativ auf automatisierte Content-Erstellung setzt, riskiert Reichweite und Glaubwürdigkeit. Wie Deloitte-Expertin Sophie Pastowski anmerkt, braucht es dringend „transparente Kennzeichnung, um Vertrauen im digitalen Raum zu stärken.“ Genau hier entsteht ein massiver Zukunftsmarkt für „Trust-Tech“-Start-ups: Werkzeuge, die Authentizität verifizieren, Deepfakes zuverlässig herausfiltern, digitale Wasserzeichen etablieren oder Content-Provenance (Herkunftsnachweise) sichern, werden zu kritischen Erfolgsfaktoren für Plattformen und Verlage.

Streaming-Kollaps: Die Sehnsucht nach dem Super-Aggregator

Auch im Video-Streaming-Markt (SVoD) stehen die Zeichen auf Wandel. Der Markt ist in einer Reifephase angekommen: Zwar verbringen die Deutschen immer mehr Zeit mit Streaming, doch die Abo-Zahlen stagnieren. Mit durchschnittlich 2,5 Abos bei 64 Prozent der Haushalte ist die finanzielle und nervliche Schmerzgrenze offenbar erreicht.

Die Fragmentierung des Marktes wird zum Bumerang. Die Hälfte der Konsument*innen findet das zersplitterte Angebot unübersichtlich; das ständige Suchen nach Inhalten über verschiedene Apps hinweg („Decision Fatigue“) nervt. Das Resultat ist ein lauter Ruf nach Bündelung: 43 Prozent der Nutzer*innen wünschen sich eine plattformübergreifende Aggregation ihrer Dienste. Der Haken für Anbietende: 60 Prozent erwarten im Gegenzug für ein solches Bundle einen spürbaren Preisvorteil.

Die Start-up-Perspektive: Der Markt schreit nach einer funktionierenden Meta-Ebene. Wer es schafft, die zersplitterte Content-Landschaft in einer nutzer*innenfreundlichen Oberfläche (Super-App) mit intelligenter, plattformübergreifender Suchfunktion und klugem Pricing zu bündeln, trifft den absoluten Nerv der Zeit. Das reine Hinzufügen eines weiteren Nischen-Streamingdienstes dürfte es hingegen 2026 schwerer denn je haben.

Audio: Der harte Kampf um das knappe Gut „Glaubwürdigkeit“

Im Audio-Segment setzt sich der Strukturwandel fort. Podcasts boomen weiter und haben bei den 25- bis 34-Jährigen das klassische Radio bereits als wichtigstes Medium überholt. Doch das Radio verzeichnet mit 65 Prozent wöchentlicher Reichweite weiterhin eine enorme Resilienz. Der Grund ist ein entscheidender USP, von dem digitale Kanäle lernen können: Vertrauen. Wenn es um harte Informationen und die Nachrichtenlage geht, stufen 54 Prozent der Hörer das Radio als informativer und verlässlicher ein – Podcasts kommen hier nur auf 19 Prozent.

Fazit

Die Mediennutzung 2026 ist stark paradox geprägt: Technologie durchdringt die Erstellung von Inhalten immer tiefer, doch die Sehnsucht der Nutzer*innen nach Authentizität, Übersichtlichkeit und verlässlichen Quellen wächst proportional dazu. Für Start-ups bedeutet dies einen strategischen Paradigmenwechsel. Nicht das nächste Tool zur Erstellung von noch mehr billigem KI-Content ist der heilige Gral, sondern Lösungen, die in der Informationsflut Orientierung schaffen, Fragmentierung auflösen und echtes Vertrauen im digitalen Raum aufbauen. Wer diese Schmerzpunkte adressiert, hat im hart umkämpften Medienmarkt der kommenden Jahre exzellente Karten.

Selbstständigen-Report 2026: Wachsender Frust in der Gründer*innen-Szene

Der neue Selbstständigen-Report 2026 zeichnet das Bild einer demoralisierten Leistungsträger*innenschicht: Immer mehr Selbständige schätzen ihre wirtschaftliche Lage als prekär ein und fühlen sich von der Politik im Stich gelassen. Doch wer steckt hinter diesen alarmierenden Zahlen, und wie ist die Lage für Gründer*innen und Start-ups strategisch einzuordnen?

Herausgegeben wird der Report als Gemeinschaftsprojekt von WISO MeinBüro und dem Verband der Gründer und Selbstständigen Deutschland e.V. (VGSD). Die aktuelle Umfrage, an der sich zwischen Mitte Dezember 2025 und Mitte Februar 2026 insgesamt 2684 Personen beteiligten, zeigt die harte Realität der Solo-Selbständigen.

Nur noch knapp 46 Prozent schätzen die Lage ihres Unternehmens als gut bis hervorragend ein. Der Report zeigt einen deutlichen Abwärtstrend: 2024 waren es noch 55 Prozent, im Jahr 2018 waren es sogar 60 Prozent. Thüringen bildet 2026 mit nur rund 37 Prozent Zufriedenheit das Schlusslicht. Nur in Brandenburg scheint sich die Lage gebessert zu haben: Dort bewerteten rund 46 Prozent der Befragten die wirtschaftliche Lage ihres Unternehmens als gut.

Rund 90 Prozent der Befragten teilten mit, dass sie sich als Selbständige überhaupt nicht bis wenig von der Politik respektiert fühlen. Rund 38 Prozent der Befragten haben in den letzten zwei Jahren darüber nachgedacht, auszuwandern. Bürokratie ist dabei der potenzielle Auswanderungsgrund Nummer eins, genannt von 41,6 Prozent der Umfrageteilnehmenden.

Ein besonderer Dorn im Auge der Unternehmer*innen ist zudem das heikle Thema Scheinselbständigkeit, dessen Dringlichkeit bei vielen Befragten noch nicht vollends angekommen zu sein scheint. Im behördlichen Prüfverfahren wird immer nur ein Auftraggebender konkret angeschaut. Dieses Statusfeststellungsverfahren birgt enorme rechtliche und finanzielle Unsicherheiten bei den Selbständigen.

Ebenso sorgt neue Gesetzgebung für Unmut: Seit dem 1. Januar 2026 gilt die Aktivrente. Rentner*innen können bis zu 2.000 Euro monatlich steuerfrei dazuverdienen, wenn sie in einem Angestellt*innenverhältnis sind. Selbständige Rentnerinnen und Rentner dagegen sind weiterhin voll steuerpflichtig. Rund 81 Prozent der Befragten finden diese Ungleichbehandlung ungerecht.

Fazit

Die Hauptmotivationen, selbständig zu sein, sind – wie auch bei den letzten beiden Befragungen – eigenbestimmtes Arbeiten und flexible Arbeitszeiten. Trotz aller Widrigkeiten würden sich mehr als 83,3 Prozent der Befragten wieder selbständig machen.

So zieht Dr. Andreas Lutz, VGSD e. V., das Fazit: „Die Ergebnisse zeigen eine Mischung aus dem für Selbstständige typischen Unternehmergeist, Resilienz und Durchhaltevermögen einerseits und einem hohen Maß an Frustration über die politischen Rahmenbedingungen andererseits. Viele Selbstständige blicken nicht optimistisch, aber sehr realistisch auf die Zukunft: Sie erkennen die Herausforderungen der Zeit, leiten Maßnahmen ab, treiben ihr Geschäft aktiv voran und tragen auch in schwierigen Zeiten Verantwortung. Dieses Potenzial für Wirtschaft und Gesellschaft muss die Politik erkennen und nutzen – und Bedingungen schaffen, die es ihnen nicht weiter unnötig schwer machen. Genau darin liegt die politische Botschaft dieses Reports.“

Der gesamte Report sowie weitere Informationen stehen hier zum kostenlosen Download bereit: https://www.meinbuero.de/selbststaendigen-report-2026/