Aktuelle Events

Semantisches Web - Netz aus Möglichkeiten

Während das www stetig wächst, steht bereits die nächste Entwicklungsstufe in den Startlöchern: Welche Rolle könnte das semantische Web in der Zukunft spielen?

Aktuell analysieren Computerprogramme noch mit Algorithmen – auch Crawler genannt – die verschiedenen Suchanfragen oder Schlagworte. Dabei hängt die Genauigkeit der Antworten stark von der Eindeutigkeit der gestellten Frage ab. So kommt es schnell dazu, dass Suchmaschinen sich beispielsweise bei der Eingabe einer kompletten Frage nur auf einzelne Keywords beziehen und somit kaum die gesuchte Antwort liefern. Nutzerinnen und Nutzer, aber auch Unternehmen, verwenden diese Anwendungen jedoch häufig für einen effizienten Arbeitsfluss. Systeme müssen in diesem Zusammenhang lernen nicht nur grundlegend bestimmte Inhalte zu finden, sondern diese im besten Fall auch verstehen, um den Anwendern bestmöglich zu helfen. Hier setzt das semantische Web mit seinem Konzept an und besonders künstliche Intelligenz bietet dabei einen guten Ansatzpunkt.

Semantisches Web - mehr als nur eine Idee im Web 3.0

Dabei geht es grundlegend darum, einzelne Informationen in Beziehung zueinander zu setzen. Damit können beispielsweise Suchmaschinen Verbindungen zwischen einzelnen Stichworten erkennen und diese auch verstehen. Erste Ansätze dieser Technologie entstanden schon Anfang des Jahrtausends ausgehend vom eigentlichen Erfinder des Internets Tim Berners-Lee. Während Menschen die Fähigkeit besitzen, Texten eine Bedeutung zuzuweisen, haben Computer nicht diese Möglichkeit. Zwar nehmen sie den Text zwar wahr, aber können ihn dabei nicht verstehen. Mit der Einführung des semantischen Webs ändert sich dies jedoch. Computerprogramme haben damit die Chance, die Zusammenhänge zwischen den einzelnen Worten zu verstehen und Bürgerinnen und Bürger besser im Alltag zu unterstützen. Arbeitsschritte, die heute noch Menschen ausführen, sollen Anwendungen in der Zukunft automatisch übernehmen. Für viele scheint diese Entwicklungsstufe des Web 3.0 noch komplette Zukunftsmusik, aber Fachleute beobachten beinah täglich den anhaltenden Fortschritt des neuen Systems – aktuell besonders im Bereich der Chatbots wie ChatGPT.

Künstliche Intelligenz macht erste Schritte

Durch die Einbindung von künstlicher Intelligenz (KI) in den Verarbeitungsprozess lässt sich die Darstellung von menschlichem Zugriff auf bestimmte Informationen oft einfacher nachahmen. Dies zeigen vor allem neuere Entwicklungen in diesem Bereich sehr gut. Gerade Programme, wie beispielsweise ChatGPT, verändern die gewohnte Internetrecherche drastisch und stellen unter anderem Google oder Wikipedia vor Schwierigkeiten, denn solche Systeme lassen sich mit semantischen Webdaten und Wissen erweitern. Zudem liefern sie ausformuliert Antworten auf gestellte Fragen in Form von kurzen Abstracts oder auch längeren Aufsätzen. ChatGPT kann dabei darauf trainiert werden, semantische Informationen zu verstehen und in natürlicher Sprache zu kommunizieren. Dies bedeutet, dass es in der Lage ist, auf Fragen oder Anfragen, die sich auf semantische Webdaten beziehen, relevante Antworten zu generieren. Dies ermöglicht auch die Integration von semantischen Suchfunktionen und Wissensdatenbanken in Chatanwendungen, um benutzerfreundlichere und informativere Interaktionen zu erleichtern.

Noch viel (Vor-)Arbeit vonnöten

Selbstverständlich braucht es jedoch einiges an Vorarbeit, bevor ein solches System erstmals wirklich in Betrieb geht. Suchmaschinen brauchen entsprechende Unterstützung, um Zusammenhänge verstehen zu können. Hier kommt unter anderem ein System namens Ressource Description Framework (RDF) zur Hand, welches Sätze in einzelne leichter verständliche Tripel zerlegt. Damit kann das Programm nach den einzelnen Bestandteilen suchen. Hier spielt auch das Thema Ontologie eine wichtige Rolle, um beispielsweise Mehrdeutigkeiten besser anzugehen. Fest steht auf jeden Fall: Der Einfluss des semantischen Webs auf die Zukunft der Suchmaschinen scheint gewaltig und die Möglichkeiten dieser nicht ganz so neuen Technologie beinah unendlich.

Der Autor Andreas Dörr ist Gesellschafter der Semantic Applications GmbH & Co. KG., das u.a. IT-Dienstleistungen und Open Source Consulting bietet,

Diese Artikel könnten Sie auch interessieren:

Produktivität statt Überstunden: Wie Echtzeitdaten das Finanzwesen von morgen steuern

Das KI-gestützte Fintech Embat beendet das Excel-Chaos im Treasury und macht Finanzteams mit Echtzeitdaten fit für die Zukunft.

Berlin, 28. April 2026 – Es ist ein bekanntes Bild in den Finanz- und Treasury-Abteilungen des deutschen Mittelstands: Wenn der Monatsabschluss naht oder Ad-hoc-Berichte für die Geschäftsführung benötigt werden, bleiben die Schreibtischlampen bis spät in die Nacht an. Die manuelle Zusammenführung von Daten aus unterschiedlichen Bankportalen und historisch gewachsenen Excel-Listen kostet nicht nur Nerven, sondern vor allem wertvolle Zeit.

Das schnell wachsende Fintech Embat tritt an, um genau diesen Engpass aufzulösen. André Reimers, Head of DACH, treibt diese Mission im deutschsprachigen Raum als Gesicht des Unternehmens voran. Seine Kernüberzeugung: Wer heute noch regelmäßig Überstunden machen muss, um finanzielle Transparenz zu schaffen, leidet nicht unter mangelnder Einsatzbereitschaft – er leidet unter einem strukturellen Datenproblem.

Beeindruckendes Wachstum durch das Lösen echter Pain Points

Dass der Schmerz in den Finanzabteilungen groß und der Bedarf an modernen Lösungen riesig ist, belegen die Zahlen, mit denen Embat den europäischen Markt aufrollt. Mit einem starken Kundenwachstum im deutschen Markt von über 250 Prozent im vergangenen Jahr und mittlerweile mehr als 400 mittelständischen und großen Unternehmenskunden weltweit hat sich das Fintech als fester Player etabliert. Das stetig wachsende Transaktionsvolumen von 250 Millionen Euro zeigt deutlich: Der Wechsel von fehleranfälligen Tabellen zu automatisierten Cloud-Lösungen ist in vollem Gange.

Der Weg aus der Excel-Falle

Mit seiner Technologie nimmt Embat den Kampf gegen ineffiziente Prozesse im Treasury auf. Anstatt hochqualifizierte Mitarbeiter mit repetitiver Datenpflege zu binden, automatisiert das System die Konsolidierung aller relevanten Finanzdaten.

„Die Erwartungshaltung, dass komplexe Finanzanalysen zwingend mit langen Abenden im Büro einhergehen müssen, ist schlichtweg nicht mehr zeitgemäß“, erklärt André Reimers. „Wenn Cashflow, Liquidität und Runways per Knopfdruck in Echtzeit abrufbar sind, ändert sich die gesamte Arbeitsdynamik. Finanzteams können aus dem reaktiven Modus heraustreten und sich auf die strategische Steuerung des Unternehmens konzentrieren.“

Hohe Innovationskraft trifft auf lokales DACH-Verständnis

Embat profitiert von einer enormen Innovationsgeschwindigkeit und Agilität, auf der die starke technologische Basis des Unternehmens beruht. Wie diese passgenau auf die spezifischen Bedürfnisse des deutschen Marktes übersetzt wird und für eine hohe lokale Marktpräsenz sorgt, zeigt André Reimers an den Standorten in München und Berlin.

Von diesen beiden Standorten aus steuert André Reimers das DACH-Geschäft und stellt das tiefe Verständnis für die komplexen Strukturen und hohen Sicherheitsbedürfnisse des deutschen Mittelstands sicher. Das Team zeigt dabei, wie moderne, dezentrale Zusammenarbeit erfolgreich funktioniert. Das Vertrauen der stetig wachsenden deutschen Kundenbasis fußt dabei auf dieser geballten lokalen Expertise gepaart mit der unerschütterlichen Zuverlässigkeit der Systeme.

Führen durch Resultate, nicht durch Anwesenheit

Die Botschaft an die Finanzwelt ist klar: Moderne Führung, hohe Produktivität und Skalierbarkeit erfordern keine starren Kontrollmechanismen oder endlosen Arbeitstage. Sie erfordern radikale Datentransparenz und die richtigen digitalen Werkzeuge. Wenn die Daten in Echtzeit fließen, sinkt die Fehlerquote, die Entscheidungsgeschwindigkeit steigt – und die systembedingten Überstunden im Treasury gehören endgültig der Vergangenheit an.

Über Embat:

Embat ist ein KI-gestütztes FinTech mit Schwerpunkt auf Treasury-Management, das es mittelständischen Unternehmen und Großkonzernen ermöglicht, ihre Finanzprozesse in Echtzeit zu zentralisieren. Gegründet von Antonio Berga und Carlos Serrano – ehemaligen J.P. Morgan-Managern mit umfassender Erfahrung im Corporate Banking – sowie Tomás Gil, dem ehemaligen CTO von Fintonic, entstand die Plattform mit der Mission, die Finanzabteilung zu digitalisieren. Die klare Prämisse dabei: Technologie von Finanzexperten für Finanzexperten.

Durch seine hybride Konnektivität lässt sich Embat in über 15.000 Banken und führende ERP-Systeme integrieren und beseitigt so jegliche Datenfragmentierung. Das wichtigste Alleinstellungsmerkmal ist TellMe, ein „Agentic Treasury Analyst“ (autonomer KI-Analyst), der Cashflow-Muster erkennt, komplexe Kontenabstimmungen automatisiert und strategische Entscheidungen zur Optimierung der Liquidität vorschlägt.

Mit Niederlassungen in Madrid, London, Berlin und München definiert Embat die Zukunft des Corporate Finance neu.

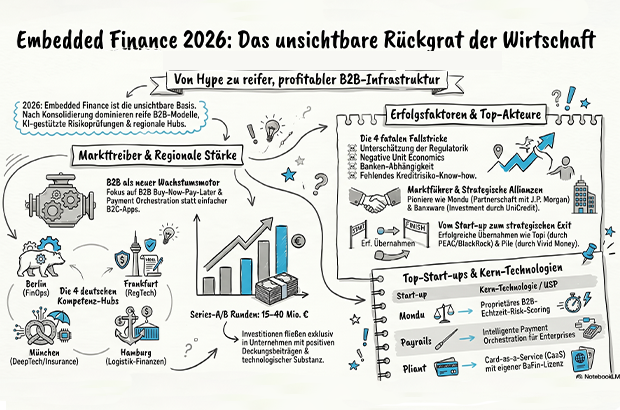

Embedded-Finance-Start-up-Report 2026

Der unsichtbare Bankensektor: Wie Embedded Finance und die dazugehörigen Start-ups die Wirtschaft des Jahres 2026 prägen.

Einst war es das große Versprechen für eine Handvoll hipper Neobanken, heute ist es das unsichtbare Rückgrat der europäischen Wirtschaft: Embedded Finance. Im Jahr 2026 wird das Marktwachstum längst nicht mehr von der fixen Idee isolierter Bank-Apps dominiert, denn jedes zukunftsorientierte Unternehmen ist mittlerweile selbst zu einem/einer Finanzdienstleister*in geworden. Ob Software-as-a-Service-Anbieter*in, Logistik-Plattform oder Marktplatz – die nahtlose Integration von Zahlungen, Krediten und Versicherungen in nicht-finanzielle Kund*innenreisen ist das neue Paradigma.

Dieser Report beleuchtet eine Branche, die den „Sturm der Konsolidierung“ überlebt hat und nun mit reifen Geschäftsmodellen und echten Profiten die Architektur der modernen Wirtschaft neu programmiert.

Vom Hype zur fundamentalen Reife

Nach den massiven Zinsanpassungen und regulatorischen Aufräumarbeiten der Jahre 2023 und 2024 zeichnet der Embedded-Finance-Markt heute ein Bild robuster Reife. Renommierte Analystenhäuser wie Bain & Company und Dealroom haben diese Entwicklung früh vorgezeichnet: Der globale Markt für Embedded-Finance-Dienstleistungen hat sich in ein Multimilliarden-Segment verwandelt, dessen europäisches Transaktionsvolumen mittlerweile signifikante Teile des digitalen B2B- und B2C-Handels stützt. Der technologische Haupttreiber dieser neuen Ära ist unbestreitbar die künstliche Intelligenz, genauer gesagt proprietäre Machine-Learning-Modelle, die Risikobewertungen in Millisekunden durchführen und Transaktionsströme dynamisch optimieren. Investor*innen honorieren diese technologische Tiefe: Wir sehen heute höchst realistische Series-A- und Series-B-Runden im Bereich von 15 bis 40 Millionen Euro für Start-ups, die nachweislich positive Deckungsbeiträge aufweisen. Es fließt wieder signifikant Kapital, doch es fließt exklusiv in Substanz und Skalierbarkeit, nicht mehr in reines Marketing.

Die neuen Treiber: B2B, Vertikalisierung und Orchestrierung

Wenn man über das Offensichtliche wie einfache White-Label-Kreditkarten hinausblickt, dominieren im Jahr 2026 drei spezifische Sub-Sektoren den Markt. Allen voran steht B2B Buy-Now-Pay-Later, eine Disziplin, die das traditionelle, schwerfällige Factoring abgelöst hat und nun direkt in B2B-Checkouts und Beschaffungsnetzwerke integriert ist. Ein weiterer massiver Treiber ist die sogenannte Payment Orchestration für vertikale SaaS-Lösungen. Hier werden komplexe, branchenspezifische Zahlungsflüsse – etwa im Handwerk oder in der Gastronomie – automatisiert im Hintergrund abgewickelt. Zuletzt etabliert sich Embedded Insurance zunehmend im Industriekontext, wo Maschinen nicht mehr nur geleast, sondern im selben Atemzug transaktionsbasiert versichert werden. Pioniere wie die Berliner Mondu oder auch europäische Schwergewichte wie Swan haben den Weg für diese hochspezialisierten Infrastruktur-Layer geebnet und gezeigt, wie tiefgreifend diese Geschäftsmodelle in die Wertschöpfungsketten der Realwirtschaft eingreifen.

Die Lektionen der BaaS-Krise

Doch dieser Reifegrad wurde teuer erkauft. Der Beinahe-Kollaps des britischen Banking-as-a-Service-Pioniers Railsr und die drastischen BaFin-Sonderprüfungen samt Wachstumsbeschränkungen bei etablierten deutschen Playern wie Solaris in den Jahren zuvor haben den Markt fundamental erschüttert. Der Traum, Finanzdienstleistungen wie einfache Legosteine zusammenzustecken, kollidierte brutal mit der harten Realität des Bankwesens.

Aus diesen gescheiterten Hoffnungen lassen sich für heutige Gründer*innen vier konkrete, fatale Fallstricke ableiten. Der erste und wichtigste ist die eklatante Unterschätzung der Regulatorik; Compliance lässt sich nicht auslagern, und Aufsichtsbehörden dulden keine agilen Versuch-und-Irrtum-Prozesse bei der Geldwäscheprävention. Der zweite Fallstrick ist die Falle der negativen Unit Economics im B2C-Sektor, wo exorbitante Kund*innenakquisitionskosten oft nur durch kontinuierliches VC-Geld gedeckt wurden. Drittens das Klumpenrisiko der Abhängigkeit von einer einzigen Partnerbank, deren Ausfall das eigene Start-up über Nacht handlungsunfähig macht. Und viertens die Fehlannahme, dass Technologie allein ausreicht; wer heute kein tiefes Verständnis für klassisches Bilanzstruktur- und Kreditrisikomanagement mitbringt, scheitert unweigerlich.

Das deutsche Netzwerk: Die Schmieden der Infrastruktur

Deutschland hat sich in dieser Konsolidierungsphase als einer der resilientesten Standorte in Europa bewiesen, getragen von vier essenziellen Hubs. Berlin verteidigt dabei seinen Status als unangefochtene Hauptstadt für FinOps und B2B-Zahlungsinfrastruktur, massiv befeuert durch die Talent-Pipelines der TU Berlin sowie das dichte Netzwerk an Serial Entrepreneurs aus der N26- und SumUp-Schule. Frankfurt am Main bildet den unverzichtbaren regulatorischen Gegenpol; hier, im Schatten von EZB und BaFin, entstehen im Umfeld des TechQuartiers und der Frankfurt School of Finance and Management jene Start-ups, die komplexe Compliance- und Treasury-Architekturen für Großbanken bauen. München dominiert den Bereich DeepTech und Embedded Insurance im industriellen B2B-Kontext, was auf die herausragende Stellung des Center for Digital Technology and Management (CDTM) und die enge Verzahnung mit der ansässigen Versicherungs- und Automobilindustrie zurückzuführen ist. Hamburg schließlich hat sich als europäischer Hotspot für Trade Finance und in Logistikketten eingebettete Finanzierungen etabliert, gestützt durch die traditionelle Stärke der Hansestadt im globalen Handel.

Investor*innen-Radar

Das Ökosystem der Geldgeber*innen hat sich im Jahr 2026 stark differenziert und professionalisiert. An der Spitze der spezialisierten VCs agieren Fonds wie FinTech Collective und Motive Ventures (hervorgegangen aus der Übernahme des Berliner VCs embedded/capital), die mit tiefem technologischen Verständnis gezielt in Infrastruktur-Layer investieren. Unter den Top-Tier Generalisten ragen Cherry Ventures, Earlybird und Point Nine heraus, die insbesondere Series-A-Runden bei überzeugenden B2B-SaaS-Modellen anführen.

Ein starker Motor sind zudem Corporate VCs und bankennahe Fonds geworden: CommerzVentures, als unabhängiger Player, treibt Themen wie Climate-Fintech massiv voran, während CVCs der Realwirtschaft wie Allianz X und Porsche Ventures strategisch in Start-ups investieren, die sich nahtlos in ihre eigenen vertikalen Ökosysteme einklinken lassen. In der kritischen Frühphase wird der Markt von einer hochgradig vernetzten Gruppe aus Business Angels angetrieben, die nicht nur erstes Kapital, sondern vor allem regulatorisches Know-how und entscheidende Bankennetzwerke einbringen

Die Top Start-ups (Must-Watch)

Für die nachfolgende Liste der Must-Watch-Unternehmen haben wir strikte Kriterien angelegt. Die Auswahl basiert auf nachgewiesener Marktrelevanz durch echte Kund*innenimplementierungen, einem hohen technologischen Reifegrad und einem diversifizierten Ansatz bei der Lösung komplexer Finanzinfrastrukturprobleme. Zudem war ein nachhaltiges Investoren-Vertrauen in den letzten zwölf Monaten ein Schlüsselfaktor. Wir beleuchten hierbei ausschließlich Start-ups mit Hauptsitz in Deutschland, deren Gründung im Jahr 2020 oder später erfolgte, um die wahre nächste Generation der Branche abzubilden.

Banxware

Das 2020 von Miriam Wohlfarth und Jens Röhrborn gegründete Banxware hat sich als Marktführer für Embedded Lending in Deutschland etabliert. Banxware bietet eine White-Label-Lösung, mit der Marktplätze und Zahlungsdienstleister*innen ihren Händler*innen Sofortkredite basierend auf historischen Umsatzdaten anbieten können. Der USP liegt in der extrem schnellen Risikoprüfung und der nahtlosen API-Integration in bestehende Plattformen. Das enorme Vertrauen der Finanzbranche in dieses Modell spiegelt sich massiv auf Investor*innenseite wider: Neben frühen Leadern wie Element Ventures (heute 13books Capital) ist insbesondere der Einstieg der Großbank UniCredit ein Ritterschlag. Die Bank führte nicht nur die Series-A-Runde an, sondern legte Mitte 2025 mit einem weiteren strategischen Millionen-Investment nach, um die europäische Expansion von Banxware gemeinsam voranzutreiben.

Pliant

Im Jahr 2020 von Malte Rau und Fabian Terner aus der Taufe gehoben, definiert Pliant den Markt für B2B-Kreditkarten und Ausgabenmanagement neu. Das B2B-SaaS-Modell kombiniert eine moderne Karteninfrastruktur mit einer tiefen API-basierten Integration in Buchhaltungs- und ERP-Systeme. Der technologische Vorsprung liegt im eigenen Card-as-a-Service-Angebot (CaaS), das anderen B2B-Plattformen den Launch eigener Kreditkartenprogramme ermöglicht. Ein entscheidender Meilenstein war hierfür der Erhalt der eigenen E-Geld-Lizenz der BaFin, die Pliant die nötige regulatorische Unabhängigkeit verleiht. Unterstützt wird Pliant von namhaften Investoren wie SBI Investment, Alstin Capital – und einem Investment des globalen Schwergewichts PayPal Ventures, das das enorme Skalierungspotenzial der Plattform bestätigt.

Mondu

Die Serial Entrepreneurs Malte Huffmann, Philipp Povel und Gil Danziger gründeten Mondu 2021 und revolutionieren damit den B2B-Zahlungsverkehr. Ihr B2B-BNPL-Modell ermöglicht es Geschäftskund*innen, online wie B2C-Kund*innen auf Rechnung oder in Raten zu kaufen, während der Händler sofort sein Geld erhält. Die Kerntechnologie ist ein proprietäres Echtzeit-Risk-Scoring für Firmenkund*innen. Finanziert wurde diese Vision anfangs von Top-Tier-Fonds wie Valar Ventures und Cherry Ventures. Der ultimative Ritterschlag erfolgte jedoch Ende 2025: Neben dem Erhalt der E-Geld-Lizenz sicherte sich Mondu eine 100-Millionen-Euro-Fazilität von J.P. Morgan Payments inklusive einer strategischen Partnerschaft, um die Buy-Now-Pay-Later-Lösung dem europäischen Kund*innen stamm der US-Großbank anzubieten.

Payrails

Gegründet 2021 von Orkhan Abdullayev, Emre Talay und Nicolas Thouzeau, löst Payrails die Herausforderung der Payment Orchestration. Das FinOps-Start-up baut ein intelligentes Betriebssystem für Zahlungen, das Transaktionen für Enterprise-Kund*innen dynamisch über verschiedene Provider routet, um Kosten zu senken und Autorisierungsraten zu maximieren. Die technologische Brillanz dieser Architektur lockte früh Schwergewichte wie Andreessen Horowitz und EQT Ventures an. Im Sommer 2025 zündete Payrails die nächste Stufe: HV Capital führte eine massive Series-A-Runde über 32 Millionen US-Dollar an, bei der auch alle Top-Tier-Altinvestoren erneut mitzogen, um die globale Expansion der Plattform endgültig zu sichern.

Finmid

Die beiden N26-Alumni Max Schertel und Alexander Talkanitsa starteten Finmid 2021 mit der Mission, jede B2B-Plattform zu einer Finanzierungsquelle zu machen. Ihr Geschäftsmodell fokussiert sich auf Embedded B2B Lending, das speziell auf die Anforderungen von Marktplätzen (wie etwa dem Partner Wolt) zugeschnitten ist – ohne dass diese Plattformen eigenes Kapital bereitstellen oder Risiken tragen müssen. Ihr USP ist die radikale Simplifizierung der B2B-Kreditvergabe durch smarte Echtzeit-Datenverknüpfungen. Angetrieben von einer wuchtigen 23-Millionen-Euro-Series-A-Runde, angeführt vom britischen Fonds Blossom Capital und dem Seed-Lead Earlybird, treibt das Start-up seine aggressive europäische Expansion unaufhaltsam voran.

Topi (Exit)

Charlotte Pallua und Estelle Merle brachten Topi 2021 an den Start, um das Hardware-as-a-Service-Modell in den B2B-Bereich zu integrieren. Über die Plattform können B2B-Kund*innen IT-Equipment flexibel mieten, wobei Topi den gesamten Prozess vom Checkout über das Refinancing bis zum Asset-Management abwickelt. Nachdem Topi mit Händler*innen wie Cyberport massiv skalierte und von Top-VCs wie Index Ventures und Creandum finanziert wurde, erfolgte im Sommer 2025 der strategische Exit: Das FinTech wurde von dem internationalen Leasing-Giganten PEAC Solutions (einem BlackRock-Portfoliounternehmen) übernommen, um das innovative B2B-Mietmodell global in dessen gewaltige Finanzierungsinfrastruktur einzugliedern.

Hakuna

Im Bereich Embedded Insurance schlägt das 2021 von Sebastian Jost, Rupert Mayer und Orhan Köroglu gegründete Hakuna neue Wege ein. Das Start-up bietet Händler*innen eine Plattform für Garantieverlängerungen und Produktschutzversicherungen, nahtlos integriert in den Online- und Offline-Checkout. Der USP ist ein völlig neu gedachtes, digitales Schadensmanagement, das die Abwicklung für Endkund*innen radikal vereinfacht. Finanziert von Top-VCs wie Earlybird und Visionaries Club, hat Hakuna mittlerweile den Sprung ins absolute Enterprise-Segment geschafft: Im Jahr 2025 integrierten Branchenriesen wie Vorwerk, STIHL und Mister Spex die Embedded-Technologie des Start-ups, um ihre eigenen, maßgeschneiderten Produktschutzprogramme europaweit zu skalieren.

Pile (Exit)

Jessica Holzbach startete Pile 2022 und pivotierte das Modell nach dem Krypto-Winter erfolgreich zu einem hochspezialisierten Treasury-Angebot für Start-ups. Die B2B-SaaS-Technologie bündelte Konten und automatisierte die Diversifikation von Einlagen zur Risikominimierung. Das Modell erregte schnell Aufmerksamkeit und führte bereits im Sommer 2024 zu einem frühen Exit: Die 2019 gegründete Berliner Neobank Vivid Money übernahm das Start-up, um das eigene Business-Banking-Angebot mit Piles Treasury-Technologie aufzurüsten – ein Paradebeispiel für die rasante Konsolidierung im FinTech-Infrastrukturmarkt.

Internationaler Ausblick & Fazit

Blickt man über die Grenzen Europas hinaus, formen sich 2026 drei gewaltige Makro-Trends, die den deutschen Markt unausweichlich verändern werden. Aus Asien schwappt die Architektur für grenzüberschreitende Echtzeit-Settlements basierend auf regulierten Stablecoins und digitalen Zentralbankwährungen heran, was das traditionelle Korrespondenzbankensystem massiv unter Druck setzt. Die USA hingegen dominieren die Entwicklung der KI-gesteuerten autonomen Finanzen, bei der das Corporate Treasury von Algorithmen gesteuert wird, die ohne menschliches Zutun Liquidität verschieben. Aus Indien lernen wir, wie Identity-as-a-Service untrennbar mit dem Zahlungsverkehr verschmilzt und Betrug nahezu ausmerzt.

Für Gründer*innen und Investor*innen im DACH-Raum bedeutet dies: Der Fokus muss radikal auf Profitabilität, wasserdichter Compliance und extrem stabiler Infrastruktur liegen. Wer heute in Embedded Finance gewinnt, baut keine bunten Apps mehr, sondern die hochkomplexen, unsichtbaren Stahlträger der digitalen Weltwirtschaft.

ESTER Biotech: Vom Friedhofskompost zur Plastik-Revolution

Ein Enzym vom Leipziger Südfriedhof soll das weltweite Plastikproblem lösen. Das 2025 als Uni-Spin-off gegründete Start-up ESTER Biotech verspricht, schwer recycelbares PET in Rekordzeit in seine Grundbausteine zu zerlegen. Doch auf dem Weg vom Labor in die industrielle Skalierung warten das berüchtigte „Valley of Death“ – und ein scheinbar übermächtiger Konkurrent.

Der Ursprung einer potenziellen industriellen Revolution liegt ausgerechnet auf einem Komposthaufen des Leipziger Südfriedhofs. Hier suchten Forschende der Universität Leipzig gezielt nach Mikroorganismen zur Zersetzung pflanzlicher Biopolymere und stießen auf das Enzym PHL7. Was in vielbeachteten Publikationen begann, mündete im Frühjahr 2025 in der offiziellen Ausgründung der ESTER Biotech GmbH.

Das Gründer-Quartett um die Geschäftsführer Dr. Ronny Frank und Martin Hirschfeld, den wissenschaftlichen Kopf Dr. Christian Sonnendecker (der das Enzym maßgeblich mitentdeckte) sowie den verfahrenstechnischen Leiter Madalin Ceausescu hat ein klares Ziel: das chemisch-biologische Recycling von Kunststoffen auf ein neues Level zu heben. Möglich machte diesen Schritt eine millionenschwere exist-Forschungstransfer-Förderung.

Für klassische Investor*innen sei die frühe Laborphase technologisch meist noch zu riskant, erklärt Christian Sonnendecker. Genau hier setzte das Programm an: „Der exist-Forschungstransfer hat für uns die Lücke zwischen akademischem Proof-of-Concept und einem investierbaren DeepTech-Start-up geschlossen“, betont der Gründer. „Wir konnten den Recyclingprozess vom Labormaßstab von einem Liter auf 100 Liter skalieren, neue Konzepte realisieren und das Verfahren validieren.“

Was passiert im Bioreaktor mit schmutzigem Müll?

Das technologische Versprechen ist enorm: Das modifizierte Enzym zerlegt selbst schwer recycelbares PET – wie Multilayer-Verpackungen – bei moderaten 65 Grad Celsius und Reaktionszeiten von unter 6 Stunden. Daraus kann neuwertiges, lebensmittelechtes Plastik entstehen. Doch wie reagiert das System in der Realität auf stark kontaminierten Haushaltsmüll? „Wir haben bislang keinen echten Show-Stopper gesehen“, sagt Sonnendecker pragmatisch. Er verzichtet auf romantische Labor-Illusionen und ordnet die Fakten nüchtern ein: „Enzyme gelten als empfindlich, aber in der Praxis arbeiten sie erstaunlich resilient. In den typischen Abfallfraktionen, die wir getestet haben, führen Störstoffe aus Haushaltsverpackungen nicht zu kritischen Aktivitätsverlusten.“

Der tatsächliche Flaschenhals sei nicht die Biologie, sondern die Wirtschaftlichkeit: „Je stärker eine Abfallfraktion kontaminiert ist, desto geringer die Ausbeuten, begleitet mit höherem Aufwand bei Aufarbeitung und Reinigung der Produkte. Das erhöht die Kosten.“

Ein patentierter Moat – mehr als nur ein KI-Hype

Um die Enzyme rasant an neue Herausforderungen anzupassen, nutzt ESTER eine patentierte, KI-gestützte Screening-Technologie. Ist das ein echter Schutzwall gegen gut finanzierte BioTech-Labore in Asien oder den USA? Sonnendecker relativiert den reinen Algorithmus-Hype mit einem treffenden Vergleich: „KI ist heute kein exklusives Werkzeug mehr. Als Schreiben zugänglich wurde, bedeutete das nicht, dass plötzlich jeder ein guter Autor war.“

Der wahre Moat („Burggraben“) liege vielmehr in der eigenen Hardware und der Datenqualität: „Unser patentierter Ansatz basiert auf einer Messmethode, die den Kunststoff mittels Elektrizität selbst beobachtet. Dadurch erhalten wir multiparametrische und hochqualitative Daten. Der eigentliche Moat entsteht deshalb nicht durch ein einzelnes ‚Superenzym‘, sondern durch die integrierte Plattform und den Blick auf das Große.“

Regulatorik als Treiber

Der globale Markt für recyceltes PET (rPET) wird aktuell auf rund 5 Millionen Tonnen beziffert. Angetrieben wird das Wachstum durch strenge EU-Vorgaben (PPWR), die ab 2026 greifen und das Ende des billigen Neu-Plastiks einläuten. Aber was passiert, wenn Plastik aus Erdöl politisch geduldet und weiterhin deutlich billiger bleibt? „Natürlich ist Neu-Plastik aus Erdöl in vielen Fällen günstiger“, räumt Sonnendecker ein. „Aber dieser Preisvorteil basiert auf einer von fossilen Ressourcen abhängigen, linearen Wertschöpfungskette – also einer Sackgasse.“

Deutlicher wird der Gründer beim Blick auf die Konkurrenz. Der französische Marktführer Carbios bindet bereits Giganten wie L'Oréal oder Nestlé an sich. Droht ESTER den Anschluss zu verlieren? „Wir beäugen die Entwicklung von Carbios mit Skepsis“, teilt Sonnendecker selbstbewusst aus.

Tatsächlich geriet der Branchenprimus zuletzt ins Straucheln: Anfang 2025 kündigte Carbios einen drastischen Stellenabbau an, der Bau der ersten industriellen Anlage im französischen Longlaville musste aus Finanzierungsgründen auf 2028 verschoben werden. Stattdessen fokussieren sich die Franzosen nun auf ein Joint Venture mit dem chinesischen PET-Hersteller Wankai, um ab 2026 eine Anlage in Asien hochzuziehen.

Für Sonnendecker ein klares strategisches Warnsignal: „Wir sehen hier die Gefahr, dass europäische Technologie abwandert und genau jene industrielle Resilienz in Europa nicht entsteht, die so wichtig für unsere Unabhängigkeit wäre.“ Der Mitgründer ergänzt: „Weiterhin geht uns Carbios nicht weit genug, denn die Technologie bietet noch viel mehr. Wir konzentrieren uns gezielt auf bislang nicht verwertbare PET-Ströme, die heute in der Verbrennung landen und wollen in Synergie mit mechanischen Recyclern gehen. Und dabei ist PET nur der Anfang: Unser Ziel ist es, aktiv die Kunststoffwelt von morgen mitzugestalten, indem wir unsere Technologien bei der Entwicklung neuer Kunststoffe nach dem Prinzip Design for Circularity ins Spiel bringen. Wir setzen dabei auf die Werkzeuge der Natur, Enzyme, um zukunftsfähige Lösungen skalierbar zu machen und der nächsten Generation von Kunststoffen den Weg in den Markt zu ebnen.“

Die unweigerliche Millionenfrage

ESTER positioniert sich als Angreifer, doch im Jahr 2026 beginnt die kritische Phase. Der Sprung in den industriellen Dauerbetrieb ist in der Biotechnologie historisch extrem kapitalintensiv – das klassische „Valley of Death“. Da die öffentlichen Fördermittel auslaufen, sind nun echte Venture-Capital-Millionen gefragt. Wie will das Start-up überleben, ohne direkt die Mehrheit an Großinvestor*innen abgeben zu müssen?

„Für uns ist entscheidend, nicht in die klassische Falle zu laufen, alles auf eine kapitalintensive eigene Anlage zu setzen“, erklärt der Gründer seine Strategie. Demonstrations- und Pilotanlagen würden lieber angemietet statt selbst gebaut. „Das reduziert den Kapitalbedarf in dieser kritischen Phase erheblich.“ Für die anstehenden Verhandlungen mit großen VC-Fonds zeigt er sich kompromisslos: „Wir kommen nicht aus einer Position des Zwangs, sondern mit validierter Technologie, ersten Umsätzen, starken Partnern und klaren Skalierungspfaden.“

Schluss mit Swipen: Wie vibe deep aus Dating-Frust ein Relationship-Business machen will

Dating-Apps frustrieren, die Einsamkeit wächst. Das Hamburger Start-up vibe deep setzt daher auf „Deep Talk“ statt Swiping. Eine Analyse des neuen Geschäftsmodells, das beweisen will, dass sich mit emotionaler Tiefe ein skalierbares Tech-Unternehmen aufbauen lässt.

Die makroökonomischen und gesellschaftlichen Vorzeichen für eine Neuausrichtung digitaler sozialer Dienste sind eindeutig. Weltweit gilt laut der Weltgesundheitsorganisation (WHO) mittlerweile jede sechste Person als einsam. Allein in Deutschland geben über 42 Prozent der Bevölkerung an, in regelmäßigen Abständen Einsamkeit zu verspüren. Gleichzeitig zeigen klassische, auf raschen Konsum ausgelegte Dating-Apps massive Ermüdungserscheinungen. Die aktiven Nutzer*innenzahlen von Branchengrößen wie Tinder, Bumble und Hinge fielen im vierten Quartal 2024 global um sechs Prozent. Rund 69 Prozent aller heruntergeladenen Dating-Apps werden bereits innerhalb eines Monats wieder gelöscht.

Vor allem die junge Zielgruppe zieht Konsequenzen: Im Jahr 2024 planten 63 Prozent der Generation Z einen bewussten „Social-Media-Detox“ – mehr als jede andere Generation. Der Markt verlangt ganz offensichtlich nach echter Verbindung statt nach oberflächlichem, medialem Dopamin, welches das Fehlen realer Nähe oftmals nur vernebelt.

Genau in diese Lücke der wachsenden Dating-Ermüdung stößt die App vibe deep, mit der das Hamburger Start-up von Lui und Saskia Michalski den Fokus konsequent auf Deep Talk statt Swiping verschiebt.

Vom Content zum Tech-Produkt

Dabei war der Weg zum Tech-Unternehmen für die Gründer*innen, die zunächst als Content-Creator*innen im Bereich nicht-monogamer Lebensweisen erfolgreich wurden, keine klassische Laufbahn. Doch der Schritt in die Tech-Branche war eine logische Konsequenz aus dem wachsenden Frust ihrer Community. „Der Schlüsselmoment war eigentlich ein schleichender“, erinnert sich Saskia. Jahrelang hätten sie fehlende Tiefe und Einsamkeit thematisiert, doch die Probleme der Menschen seien eher gewachsen als geschrumpft. „Content allein bringt Menschen nicht ins Handeln“, konstatiert Saskia. „Er schafft Bewusstsein, aber keine echte Veränderung.“ Daraus sei der Entschluss gereift, ein Werkzeug zu bauen, das konkrete Interaktion ermöglicht.

Lui ergänzt: „Genau daraus ist vibe deep entstanden: als Produkt, nicht als Content-Verlängerung.“ Um das Vorhaben umzusetzen, übernahm er dank seines Hintergrunds in der Tech-Industrie das Product Management. Unterstützt werden die beiden von einem externen CTO, der die Entwicklung mit einem internationalen Team vorantreibt. Doch die Technik sei nur die halbe Miete: „Die eigentliche Innovation liegt nicht nur in der Technologie, sondern im Verständnis von Beziehungen – und genau das bringen wir als Gründer*innen mit“, betont Lui.

Deep Talk statt Dauerkonsum

Im Gegensatz zu bestehenden Plattformen, die auf die Quantität neuer Kontakte ausgelegt sind, setzt vibe deep auf die Intensivierung bereits bestehender Beziehungen. Der Mechanismus ist simpel, aber wirkungsvoll: Die App liefert den Nutzenden individuell angepasste Anregungen und stellt tiefgreifende psychologische Fragen – etwa zum persönlichen Umgang mit Konflikten. Der entscheidende Clou zur Steigerung des Engagements liegt darin, dass die Antworten erst ersichtlich werden, wenn alle beteiligten Parteien sich mit ihren eigenen Erwartungen auseinandergesetzt und diese in der App beantwortet haben.

Flankiert wird dieses Konzept von einer künstlichen Intelligenz, deren Nutzung jedoch streng an die Zustimmung aller Beteiligten geknüpft ist. Gerade beim Umgang mit hochsensiblen Paardaten stellt sich unweigerlich die Frage nach Datensicherheit. Auf Nachfrage versichert Lui strenge Standards: „Wir bauen kein Produkt, das ohne Vertrauen funktionieren kann.“ Er verweist auf Datensparsamkeit, pseudonymisierte Strukturen und die klare Regel, Inhalte nicht für das Training von KI-Modellen zu nutzen.

Saskia präzisiert den ethischen Rahmen der Technologie: Die KI sei darauf ausgelegt, „nicht zu bewerten oder Lösungen vorzugeben, sondern Verbindung zu fördern durch Spiegeln, Nachfragen und Perspektivwechsel“. Dabei bleiben die Algorithmen bewusst in einer unterstützenden, nicht-dominanten Rolle und greifen nur ein, wenn beide Partner*innen dies explizit wünschen. Den Kern ihres Anspruchs fasst Saskia pointiert zusammen: „Die intimsten Gespräche eines Menschen gehören nicht uns – wir dürfen nur den Raum dafür halten.“

Community-Power als Raketenstart im Haifischbecken

Mit über 600.000 Follower*innen über alle sozialen Netzwerke hinweg verfügt das Duo über eine immense organische Reichweite. Diese schlägt sich in den Startmetriken der App wider: In den ersten acht Wochen wurden bereits über 50.000 Fragen von den User*innen beidseitig beantwortet. Zudem verzeichnete die App in den ersten Wochen über 10.000 Installationen und konnte dabei mehr als 300 Premium-Aktivierungen vermerken.

Besonders bemerkenswert sind die emotionalen Erfolgsmetriken: Laut Unternehmensangaben bestätigen 75 Prozent der Nutzenden, dass sich ihr Verhältnis zueinander nach zehn Tagen signifikant verbessert hat. Ehrliche Kommunikation birgt jedoch auch Konsequenzen, denn laut denselben Daten endete jede zehnte Beziehung in diesem Zeitraum mit einer sofortigen Trennung.

Der Markt für „Relationship Care“ wächst und lockt international Wagniskapital an. Zu den Mitbewerbenden zählen das britische Start-up Paired sowie die US-amerikanischen Pendants Agapé und Coral. Im deutschsprachigen Raum konkurriert vibe deep unter anderem mit PAIRfect und recoupling, die durch TV-Show „Die Höhle der Löwen“ nationale Bekanntheit erlangten.

Doch wie grenzt man sich von diesen Millionen-Playern ab? „Viele der bestehenden Player bauen im Kern Therapie-Tools für romantische Zweierbeziehungen. Das bildet aber nur einen sehr kleinen Ausschnitt davon ab, was Beziehung eigentlich ist“, kritisiert Saskia Michalski. Vibe deep begreife Verbundenheit deutlich breiter – ob in Freundschaften, beim Dating oder in offenen Konstellationen. Tatsächlich nutze über die Hälfte der User*innen die App mit mehr als einer Person. „Deshalb bauen wir keine Therapie-App für Paare, sondern eine Infrastruktur für Verbindung“, resümiert Saskia.

Zwischen Viralität und Churn-Gefahr

Die Monetarisierung erfolgt derzeit über ein monatliches Abo-Modell, das dem Start-up verlässliche wiederkehrende Umsätze (MRR) sichern soll und tiefere Einblicke sowie mehr KI-Funktionen freischaltet. Für Lui war dieser erste Schritt ein erfolgreicher Test: „Die Frage war, ob Menschen grundsätzlich bereit sind, für tiefere Verbindung zu zahlen. Und die Antwort ist klar: Ja.“ Gleichzeitig räumt er ein, dass die App weniger als Daily-Produkt, sondern eher in intensiven emotionalen Peak-Phasen genutzt wird, weshalb man nun auch mit Wochen- und Jahres-Abos experimentiere. Finanziell agiert das Duo bislang völlig eigenständig („100% bootstrapped“), schließt aber externe Investor*innen für die nächste Wachstumsphase nicht aus. „In sechs Monaten können wir diese Frage also sicherlich schon deutlich präziser beantworten“, so Lui.

Das Geschäftsmodell ist ein klassisches Beispiel für die Monetarisierung innerhalb der Creator Economy. Durch die riesige Community bleiben die Akquisekosten extrem niedrig. Zudem erzeugt die Mechanik der zunächst verborgenen Antworten einen eingebauten Viral-Loop, der enorme Neugier weckt. Dennoch zeigen sich Skalierungsrisiken: Mit einer Conversion-Rate von rund drei Prozent muss vibe deep beweisen, dass es den Sprung aus der Influencer*innen-Blase in den Massenmarkt schafft.

Die größte Herausforderung bleibt das branchenbekannte „Churn-Paradoxon“: Löst die App ihr Versprechen ein und heilt die Beziehung – oder führt sie zur Trennung –, entfällt auf Dauer der primäre Use Case für die Endkonsument*innen.

Saskia widerspricht dieser Lesart jedoch energisch. Das Paradoxon basiere auf einem überholten Verständnis von Beziehungen, bei dem man ein Problem löst und dann „fertig“ sei. „Verbindung ist kein Zustand, den man einmal erreicht, sondern etwas, das sich ständig verändert“, analysiert Saskia. Weil die Nutzenden die App über mehrere Verbindungen und Lebensphasen hinweg nutzen, steige der Customer Lifetime Value ganz natürlich.

Perspektivisch plant das Start-up zudem Erweiterungen im B2B2C-Bereich, etwa als Begleit-Tool für Coaches und Paartherapeut*innen oder für das Team-Building in Unternehmen. Der Fokus bleibe vorerst jedoch auf den Endkonsument*innen. Saskia Michalski bringt die Vision selbstbewusst auf den Punkt: „Wir bauen kein Tool für ein Problem, das verschwindet, sondern für etwas, das immer wieder entsteht.“

KI gegen Beamtendeutsch: Wie ein Solo-Gründer den Markt für Nebenkosten aufrollt.

Für die meisten der rund 19 Millionen Mieterhaushalte in Deutschland ist sie ein jährliches Ärgernis: die Nebenkostenabrechnung. Laut dem Deutschen Mieterbund enthält jede zweite Abrechnung Fehler. Das fränkische Start-up NebenkostenPro will diesen intransparenten Markt nun mithilfe Künstlicher Intelligenz radikal vereinfachen – und zwar für beide Seiten.

Bisherige Lösungsansätze für fehlerhafte Abrechnungen – von unzulässigen Verwaltungskosten bis zu falsch umgelegten Reparaturen – waren für Mieterinnen und Mieter oft teuer oder zeitaufwendig. Der Gang zur Anwaltskanzlei frisst die Ersparnis schnell auf, Mietervereine binden einen an jährliche Mitgliedschaften und etablierte LegalTech-Wettbewerber verlangen für eine manuelle Prüfung meist rund 50 Euro.

Hinter dem Lösungsansatz von NebenkostenPro steht kein großes Entwicklerteam, sondern Julian Falk, ein Solo-Gründer aus Zirndorf bei Nürnberg. Auf die Frage, wie man sich freiwillig in die juristischen Untiefen der Betriebskostenverordnung stürzt, hat Falk eine verblüffend einfache Antwort: „Ehrlich gesagt war der Auslöser ziemlich banal“, erinnert sich der Gründer. „Ich habe selbst als Mieter eine Nebenkostenabrechnung bekommen, bei der die Zahlen einfach nicht plausibel wirkten“.

Als er sich einlesen wollte, landete er prompt im deutschen Paragraphendschungel. „Da habe ich gemerkt: Wenn ich als technikaffiner Mensch schon Probleme habe, das zu durchdringen, wie soll das ein normaler Mieter schaffen?“ Falk erkannte schnell, dass die Betriebskostenverordnung im Kern aus klaren Wenn-Dann-Strukturen besteht. „Das schreit förmlich nach Automatisierung“, fasst er seinen Heureka-Moment zusammen.

KI als Herausforderer im zweiseitigen Markt

Was als Wochenendprojekt begann, wuchs schnell. Heute nutzt die Plattform eine komplexe Pipeline aus mehreren KI-Modellen, um hochgeladene PDF-Dokumente und Fotos auszulesen, zu strukturieren und juristisch einzuordnen. Der Clou dabei ist der duale Ansatz, der beide Marktseiten bedient. Für Mieter*innen dient das Tool zunächst der Symptombekämpfung, indem ein initialer Schnellcheck die hochgeladenen Daten kostenlos mit lokalen Vergleichswerten abgleicht. Der detaillierte Prüfbericht startet bei einer preislichen Kampfansage von 7,90 Euro. Für Vermieter*innen fungiert die Plattform hingegen als Software-as-a-Service zur rechtskonformen Erstellung der Abrechnungen.

Dieses B2B-Abo-Modell ist für das Überleben der Firma essenziell. Es sorgt für den dringend benötigten wiederkehrenden Umsatz, der das stark saisonale, von geringer Kund*innenbindung geprägte Mieter*ingeschäft wirtschaftlich ausbalanciert.

Wer nun glaubt, hinter einer solch komplexen KI-Pipeline stünden „Heerscharen“ von Investoren, irrt. „NebenkostenPro ist komplett eigenfinanziert. Es gibt keine externen Geldgeber, keine Investoren, keine Beteiligungen“, betont Falk. Das Modell trage sich mittlerweile selbst – für Falk ein Blick in die Zukunft der Softwareentwicklung. „KI verändert gerade fundamental, wie Software-Unternehmen entstehen. Die Werkzeuge, die heute verfügbar sind, machen einen einzelnen Gründer so produktiv wie früher ein ganzes Team.“ Die Rolle des/der Entwickler*in verschiebe sich zunehmend zum/zur Architekt*in, der lediglich die Richtung vorgebe und Ergebnisse validiere.

Smarte Daten als Reichweiten-Hebel

Um gegen etablierte LegalTech-Player wie Wenigermiete oder Mieterengel anzukommen, fehlte dem Solo-Gründer schlicht das Marketingbudget. Falks clevere Antwort: Er baute eine frei zugängliche Wissensdatenbank mit kommunalen Nebenkostendaten für rund 400 deutsche Städte auf – von Grundsteuer-Hebesätzen bis zu lokalen Wasserpreisen.

Ein massiver Hebel, der sich auszahlt: Die Datenbank wird mittlerweile sogar von Google und KI-Modellen wie ChatGPT als primäre Quelle zitiert, was organischen Traffic generiert, ohne teure Klickpreise für umkämpfte Keywords zahlen zu müssen.

Konvertiert dieser Traffic auch? „Die Seite rankt für zahlreiche organische Keywords, der Traffic vervielfacht sich von Monat zu Monat“, freut sich der Gründer. Das beste Marketing sei ohnehin die Mundpropaganda erfolgreicher Nutzer*innen. Eine Entwicklung verblüfft den Zirndorfer dabei besonders: „Was mich überrascht hat: Die Vermieterseite wächst schneller als die Mieterseite.“ „Viele private Kleinvermieter kämpfen sich jedes Jahr mit Excel durch ihre Abrechnung und sind dankbar, wenn ihnen das jemand abnimmt.“

Juristisches Minenfeld und das Haftungsrisiko

Doch wo KI auf deutsches Mietrecht trifft, lauern Gefahren. Bedingt durch das Rechtsdienstleistungsgesetz darf NebenkostenPro keine formelle Rechtsberatung anbieten, sondern liefert lediglich Indizien und Muster-Widersprüche ohne bindende Vertretung. Zudem stoßen reine Sprachmodelle bei komplexen Sonderfällen – etwa einer gewerblich-privaten Mischnutzung – an ihre Grenzen.

Auf die berüchtigten „Halluzinationen“ von Sprachmodellen angesprochen, reagiert Falk pragmatisch. Er setze nicht auf ein einziges Modell, sondern auf eine spezialisierte Pipeline mit klar abgegrenzten Aufgaben. Die eigentliche Analyse basiere dann nicht auf Freitext-Antworten der KI, sondern auf einem präzisen Abgleich extrahierter Werte mit konkreten Gesetzestexten.

Zudem übt der Gründer Kritik an der generellen KI-Skepsis. „Was mich bei der Debatte um KI-Halluzinationen immer etwas stört: Wir tun so, als wäre das ein reines KI-Problem. In Wahrheit halluzinieren Menschen ständig“, kontert er. „Ein Sachbearbeiter, der zum dritten Mal an diesem Tag eine Abrechnung prüft, übersieht Fehler. Ein Vermieter, der seine Abrechnung in Excel zusammenbastelt, vertippt sich. KI lügt nicht strategisch, sie berechnet Wahrscheinlichkeiten.“

Um sich vor Regressansprüchen zu schützen, schiebt die Plattform die finale Verantwortung konsequent auf die Nutzer*innen ab. „Man muss mit KI genauso umgehen wie mit einem Kollegen. Den Output hinterfragen, nicht blind vertrauen“, mahnt Falk. Wer als Vermieter*in das Tool nutze, sei am Ende selbst für die Richtigkeit der eingegebenen Daten und das finale Dokument verantwortlich. „Bei komplexen Sonderfällen empfehlen wir ausdrücklich den Gang zur Fachberatung“, räumt er ein. Auch dem strengen Datenschutz bei Finanzdokumenten begegnet er kompromisslos: Daten kostenloser Nutzer*innen werden nach der Erstellung sofort gelöscht und alle Übertragungen werden strikt verschlüsselt.

David gegen die LegalTech-Goliaths

NebenkostenPro steht für den aktuellen Trend rund um gebootstrappte KI-Start-ups, bei denen ein(e) einzelne(r) Gründer *inmoderne Sprachmodelle nutzt, um teure menschliche Arbeitskraft zu kommoditisieren. Doch was hindert Branchenriesen mit riesigen Budgets daran, Falks Idee mittels offener KI-Schnittstellen einfach zu kopieren?

Falk gibt sich entspannt und räumt ein, dass die reine KI-Technologie kein echter Burggraben sei. Sein Vorteil liege im Domänenwissen und in der Agilität: „Als die CO2-Kostenaufteilung kam, hatte ich das schneller drin als die meisten etablierten Anbieter.“ Zudem bediene NebenkostenPro als einzige Plattform beide Marktseiten – sie prüft für die einen und erstellt für die anderen.

Am Ende, so ist sich der Gründer sicher, gewinne nicht derjenige mit dem größten Team, sondern der Schnellere. „Der Vorsprung entsteht nicht durch eine einmalige technische Idee, sondern dadurch, dass man jeden Tag nah am Nutzer baut und schneller iteriert als die Konkurrenz.“

Zwischen Bildungsdschungel und digitaler Übersicht: Kann das Münchner Start-up kursmap den Weiterbildungsmarkt knacken?

Der Markt für berufliche Weiterbildung in Deutschland ist riesig, extrem fragmentiert – und für Suchende oft frustrierend unübersichtlich. Dariusz Opitek will das Problem mit seinem Start-up kursmap – einer zentralisierten Plattform – lösen. Ein klassisches Plattform-Modell, das schnelles Wachstum verspricht, aber auch bekannte Fallstricke birgt.

Wer in Deutschland nach einer spezifischen beruflichen Fortbildung sucht, landet schnell in einem Labyrinth aus schlecht gepflegten Websites, PDF-Broschüren und intransparenten Preisstrukturen. Genau in diese Lücke stößt die 2025 in München gegründete kursmap GmbH. Erst kürzlich meldete das Start-up einen Meilenstein: Über 150.000 Kurstermine von Präsenz-, Inhouse- und Online-Schulungen sind laut Unternehmensangaben mittlerweile auf der Plattform gebündelt. Doch ist das Modell tragfähig genug, um sich gegen die etablierten Branchengrößen durchzusetzen?

Hinter kursmap steht Gründer und Geschäftsführer Dariusz Opitek. Seine Motivation entsprang einem klassischen Pain Point: Viele Interessierte wissen schlichtweg nicht, welche qualifizierten Anbieter sich in unmittelbarer Nähe befinden. Mit der Vision, „Weiterbildungen sichtbar, digital und einfach zugänglich zu machen“, brachte Opitek die Plattform an den Start.

Doch eine bloße Aggregation von Daten reicht im heutigen Tech-Umfeld selten aus. Bisher steht der Gründer stark im Vordergrund. Auf die Frage, wer neben ihm im Kernteam stehe, um dieses Mammutprojekt zu stemmen, überrascht Opitek mit einer klaren Ansage: „Kursmap ist aktuell noch eine One-Man-Show, und das bewusst.“ Er agiere als Entwickler, SEO-Stratege und Vertriebler in Personalunion. „Was manche als Schwäche sehen, ist für mich ein Vorteil: kurze Entscheidungswege, keine Overhead-Kosten, maximale Fokussierung“, argumentiert der Gründer.

Um sich gegen gut finanzierte Copycats abzusichern, braucht es allerdings einen technologischen Burggraben. Diesen sieht Opitek im Einsatz künstlicher Intelligenz. Er betont, man baue aktuell ein intelligentes Matching-System, das weit über eine klassische Suchmaske hinausgehe. „Nutzer sollen auf Basis ihrer individuellen Situation, ihrer beruflichen Ziele, dem Standort und den aktuellen Marktentwicklungen die passenden Weiterbildungen vorgeschlagen bekommen“, verspricht er. Nicht die erstbeste Option zähle, sondern die richtige. Opitek fasst den Kern seiner Technologie selbstbewusst zusammen: „Das ist keine Datenbank-Logik, das ist ein persönlicher Weiterbildungsberater, der rund um die Uhr verfügbar ist.“

Die Resterampe-Gefahr: Masse statt Klasse?

Die Marke von 150.000 Terminen ist zweifellos beeindruckend. Erreicht wurde dies, indem kursmap die Einstiegshürden für Anbieter bewusst bei null hält, sodass diese eigenständig Profile anlegen können. Genau hier liegt jedoch das größte Risiko: Marktplätze, die auf pure Quantität setzen, laufen schnell Gefahr, mit veralteten Daten oder unseriösen Angeboten der Coaching-Szene überflutet zu werden.

Wie verhindert das Start-up also, zur unregulierten Resterampe zu verkommen? Opitek wehrt sich vehement gegen den Verdacht mangelnder Kontrolle. „Ein niedriger Einstieg bedeutet nicht, dass wir die Augen verschließen, im Gegenteil“, kontert er. Laut dem Geschäftsführer werden alle Profile laufend überprüft, und es gebe klare Prozesse zum Eingreifen. Dass man auf aufwendige Onboarding-Gespräche oder intransparente Anforderungen verzichtet, sei eine sehr bewusste Entscheidung gewesen. Opitek rechtfertigt diesen Weg: „Das schadet besonders kleinen, oft hervorragenden Anbietern, die schlicht nicht die Kapazitäten für bürokratische Hürden haben.“ Sein Credo für die Plattform lautet daher: „Wer gute Kurse anbietet, soll sofort loslegen können. Qualität muss man sich nicht erzwingen, man muss sie fördern.“

Wer zahlt am Ende die Rechnung?

Das Geschäftsmodell basiert auf der kostenlosen Listung für Anbieter*innen, um zügig ein attraktives Angebot aufzubauen. Das Kalkül: Sobald darüber Leads generiert werden, lassen sich diese künftig über Premium-Modelle monetarisieren. Doch um überhaupt Lernende auf die Plattform zu locken, muss kursmap in Google Ads und im organischen Ranking hart gegen etablierte Portale kämpfen – ein Spiel, das meist massiv Kapital verbrennt.

Finanziert das Start-up diesen teuren Sichtbarkeitskampf aus eigener Kraft, oder braucht es dringend externes Venture Capital (VC)? Opitek setzt auf organisches Wachstum durch SEO. „Hochwertige, relevante Inhalte sind die nachhaltigste Investition, die eine Plattform wie kursmap machen kann“, erklärt er. Sichtbarkeit, die man sich hart erarbeite, sei langlebiger als erkaufte Reichweite. Er räumt zwar ein, ergänzend Google Ads zu nutzen, betont jedoch, dass dies hochgradig selektiv passiere. „Kursmap ist und bleibt bootstrapped“, stellt der Gründer klar. Das zwinge das Unternehmen zur Disziplin. Risikokapital sieht er derzeit eher pragmatisch: „Venture Capital ist für uns kein Ziel, sondern eine Option, die wir nur dann in Betracht ziehen würden, wenn sie uns schneller zu unserem Ziel bringt, nicht als Ersatz für ein funktionierendes Modell.“

Der B2B-Pivot: Raus aus dem Google-Hamsterrad

Kursmap agiert in einem Haifischbecken und tritt gegen Portale wie KURSNET, Semigator oder Tech-Riesen wie LinkedIn Learning an. Deutlich spannender als das margenschwache Vermittlungsgeschäft ist daher die langfristige Vision: Opitek plant B2B-Lösungen, mit denen Unternehmen ihre Weiterbildungsbudgets direkt über kursmap verwalten können. Gelingt dieser Wechsel zum B2B-SaaS-Modell, würde sich das Start-up aus der völligen Abhängigkeit vom Google-Traffic befreien.

Doch warum sollten Personalleiter*innen einem Neuling vertrauen statt auf bewährte Features ihrer HR-Software wie Personio oder Workday zu setzen? Auf die konkrete Frage nach der B2B-Strategie bleibt Opitek bei der technischen Ausführung vage und gibt offen zu: „Wie genau wir ihn gestalten, ob als eigenständiges HR-Tool oder als integriertes Feature für Unternehmen, wird die Marktentwicklung zeigen. Wir sind da ehrlich: Wir testen, lernen und passen uns an.“ Gleichzeitig grenzt er sich aber scharf von großen Suiten ab, die oft die inhaltliche Qualität von Weiterbildungsentscheidungen vernachlässigen würden. „Ein Unternehmen, das diesen Mehrwert für seine Mitarbeitenden spürt, wird kursmap nicht als Konkurrenz zu Personio oder Workday sehen, sondern als sinnvolle Ergänzung“, ist Opitek überzeugt.

Booking.com der Bildung oder teure Illusion?

Kursmap greift ein reales Problem in einem oft digital rückständigen Markt auf. Ob das Start-up langfristig aber das „Booking.com für Fortbildungen“ wird, hängt von rigoroser Qualitätssicherung, effizienter Traffic-Skalierung und der Umsetzung der B2B-Pläne ab.

Bleibt am Ende die Frage nach der Langzeitstrategie: Exit oder Industriestandard? Der Gründer strebt die Spitze im deutschsprachigen Raum an, indem man als „aktiver Partner“ fungiere. Gerade weil KI derzeit ganze Berufsbilder umkrempele, bräuchten Menschen laut Opitek keine bloßen Trefferlisten mehr.

„Kursmap soll genau diese Orientierung geben, datenbasiert, individuell, zukunftsgerichtet“, formuliert Opitek seine Ambition. Sollte dies in Deutschland greifen, schließt er eine Expansion nach Europa nicht aus. Einem unkontrollierten Hype erteilt er zum Schluss jedoch eine deutliche Absage: „Wir denken nicht in Szenarien, sondern in Meilensteinen. Erst liefern, dann skalieren.“

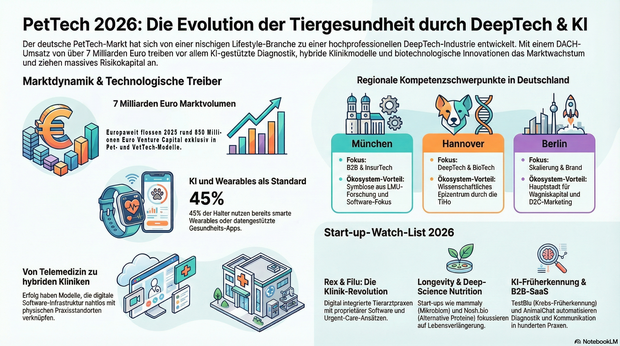

PetTech-Start-up-Report 2026

Wie DeepTech und KI den aktuellen PetTech-Markt prägen und welche Start-ups das Segment hierzulande dominieren. Plus: Die exklusive Start-up-Watch-List.

In den vernetzten De-Novo-Kliniken Berlins und Münchens scannen KI-Algorithmen heute in Millisekunden die MRT-Bilder von Haustieren, während personalisierte Longevity-Supplemente vollautomatisch an das Smart-Home der Halter geliefert werden. Der Vierbeiner des Jahres 2026 ist ein Premium-Patient und voll integrierter digitaler Lifestyle-Avatar, der eine hochkomplexe Gesundheitsökonomie antreibt. Venture-Capital-Fonds analysieren mittlerweile die Auslastungsquoten tierärztlicher Computertomographen genauso akribisch wie die wiederkehrenden Software-Umsätze im B2B-Sektor.

Wir blicken auf eine knallhart professionalisierte Industrie, in der radikale Effizienz und DeepTech den Takt angeben. Es geht um Algorithmen-gestützte Frühdiagnostik, hochskalierbare Praxis-Infrastrukturen und biotechnologische Nahrung – eine Ära, in der pure Tierliebe direkt auf tiefgreifende wissenschaftliche Innovation trifft und Investitionen in Milliardenhöhe rechtfertigt.

Ein hochreifer Milliardenmarkt unter KI-Einfluss

Der deutsche Markt für Heimtiere hat einen beispiellosen Reifegrad erreicht. Mit weit über 34 Millionen Haustieren allein in der Bundesrepublik sprechen wir von einem adressierbaren Markt, der längst nicht mehr nur Premium-Futter, sondern zunehmend hochpreisige Gesundheits- und Tech-Dienstleistungen konsumiert. Der technologische Haupttreiber im Jahr 2026 ist zweifelsohne die künstliche Intelligenz, dicht gefolgt von tiefen Integrationen des Internets der Dinge im Alltag der Tiere.

Laut einer aktuellen Bitkom-Studie nutzen mittlerweile über 45 Prozent der Halter*innen in Deutschland smarte Wearables oder datengestützte Gesundheits-Apps für ihre Tiere. Das spiegelt sich auch in den Bilanzen wider: Der Branchenumsatz im DACH-Raum hat die 7-Milliarden-Euro-Marke signifikant überschritten. Dabei flossen laut jüngsten Auswertungen von KfW Research im vergangenen Jahr europaweit rund 850 Millionen Euro Venture Capital exklusiv in Pet- und VetTech-Modelle.

Die neuen Treiber: Kliniken, Longevity und SaaS-Infrastruktur

Aktuell dominieren im PetTech-Sektor drei hochspezifische Sub-Sektoren den Markt. Allen voran steht der Bereich der De-Novo Vet-Tech-Kliniken. Hier verschmelzen physische Tierarztpraxen mit einer proprietären, durchdigitalisierten Software-Infrastruktur, die von der Terminbuchung bis zur KI-gestützten Diagnostik reicht. Etablierte Pioniere wie das Berliner Start-up Rex haben den Weg für diese hybriden Modelle geebnet.

Ein weiterer massiver Treiber ist die Pet-Longevity in Kombination mit DeepTech-Nutrition. Hier geht es nicht mehr um getreidefreies Futter, sondern um mikrobiom-basierte Nahrungsergänzungen und Alternative Proteine aus dem Bioreaktor, die das Leben der Tiere nachweislich verlängern sollen.

Der dritte dominierende Sektor ist B2B-Vet-SaaS. Start-ups bauen spezialisierte Software für Tierärzte, die Bilderkennung für Scans automatisiert und dem chronischen Fachkräftemangel in den Praxen entgegenwirkt.

Die geplatzten Träume der Solo-Telemedizin

Doch der Weg in dieses reife Marktumfeld war gepflastert mit schmerzhaften Lektionen. Der prominenteste Crash der jüngeren Vergangenheit war die spektakuläre Insolvenzwelle im Bereich der reinen Pet-InsurTechs und Solo-Telemedizin-Plattformen um das Jahr 2023 und 2024. Ein Paradebeispiel war das Berliner Neo-Versicherungs-Start-up Coya, das sich stark auf Tierversicherungen fokussiert hatte, vom französischen Konkurrenten Luko geschluckt wurde und letztlich in einem Insolvenzverfahren endete. Gleichzeitig verbrannten reine Tele-Vet-Apps, die ohne eigene physische Kliniken operierten, Millionen an VC-Geldern.

Aus diesen Debakeln lassen sich vier konkrete, fatale Fallstricke für heutige Gründer ableiten. Erstens die tödliche B2C-Kund*innenakquisitions-Falle: Wer heute im Pet-Bereich rein auf Performance-Marketing in sozialen Netzwerken setzt, wird von den astronomischen Customer Acquisition Costs erdrückt. Zweitens die Ignoranz gegenüber der Regulatorik, insbesondere der Gebührenordnung für Tierärzte. Der Gebührenschock der vergangenen Jahre brach Geschäftsmodellen das Genick, die diese Preissteigerungen nicht einkalkuliert hatten. Drittens das Dogma, dass Technologie den persönlichen Kontakt ersetzen kann: Haustiere können nicht ausschließlich über einen Bildschirm behandelt werden; wer keine physischen Anlaufstellen hat, scheitert an der Realität der Tiermedizin. Viertens die Vernachlässigung der Unit Economics zugunsten eines ungesunden Wachstums, was in einem Markt mit starker lokaler Bindung unweigerlich zum Cashflow-Kollaps führt.

Das deutsche PetTech-Netzwerk

Die deutsche PetTech-Landschaft hat sich auf wenige, aber extrem leistungsstarke Hubs konzentriert. München führt diese Liste unangefochten an. Mit der Ludwig-Maximilians-Universität, die eine der weltweit angesehensten tierärztlichen Fakultäten beheimatet, und dem InsurTech Hub Munich entsteht hier die perfekte Symbiose aus medizinischer Forschung und starkem B2B-Software-Fokus. Hannover verteidigt seinen Status als wissenschaftliches Epizentrum durch die Stiftung Tierärztliche Hochschule Hannover. Aus dem Umfeld dieser Elite-Forschungseinrichtung entspringen derzeit die tiefgreifendsten DeepTech- und BioTech-Ausgründungen der Branche. Berlin hingegen bleibt die unangefochtene Hauptstadt für Skalierung, Wagniskapital und D2C-Brandbuilding. Hier sitzen die großen Geldgeber*innen und Marketing-Genies, gestützt durch lokale Netzwerke. Leipzig komplettiert das Quartett als aufstrebender Star: Die Kombination aus der Veterinärmedizinischen Fakultät der Universität Leipzig und der BioCity, einem exzellenten Cluster für Biotechnologie, zieht zunehmend Start-ups an, die an der Schnittstelle von Tiergesundheit und Zellbiologie arbeiten.

Investor*innen-Radar

Das Kapital fließt heute intelligenter und zielgerichteter. Bei den spezialisierten VCs dominieren Fonds wie Five Seasons Ventures, die tiefes Verständnis für die Schnittstelle von FoodTech und Pet-Nutrition mitbringen, sowie global agierende Vehikel wie der Companion Fund. Im Bereich der Top-Tier Generalisten haben europäische Schwergewichte wie Cherry Ventures, Vorwerk Ventures und DN Capital den Sektor für sich entdeckt und pumpen beträchtliche Summen in hybride Klinik-Modelle und B2B-SaaS. Ein wesentlicher Machtfaktor sind mittlerweile die Corporate VCs der Industrie. Fressnapf dominiert mit seiner Beteiligungsgesellschaft die Früh- und Wachstumsphase strategisch, während Mars Petcare über seinen Arm Kinship massiv nach Europa drängt.

Der eigentliche Motor der Innovation liegt jedoch bei den Frühphasen-Motoren und Business Angels. Hier brillieren Köpfe wie Lukas Keindl, der als Gründer des US-Vorbilds Bond Vet nun aktiv sein Know-how und Kapital in die europäische Gründerszene pumpt, sowie spezialisierte Angel-Syndikate und Netzwerke wie der Auxxo Female Catalyst Fund, die gezielt diverse Gründungsteams in der Tiermedizin fördern.

Die Top-PetTech-Start-ups (Must-Watch)

Die nachfolgende Auswahl der Top Start-ups basiert auf einer strengen redaktionellen Analyse. Die zentralen Kriterien für die Aufnahme in dieses Ranking sind eine nachgewiesene Marktrelevanz durch messbares Praxis- oder Nutzerwachstum, ein hoher technologischer Reifegrad fernab reiner Konzeptphasen sowie das ausdrückliche Vertrauen namhafter Lead-Investoren. Um die aktuelle Innovationskraft des deutschen Ökosystems abzubilden, haben wir uns ausschließlich auf deutsche Start-ups konzentriert, deren Gründung im Jahr 2020 oder später erfolgte. Die Liste beleuchtet bewusst eine Diversität an Geschäftsmodellen, von B2B-Software über BioTech bis hin zu hybriden Versorgungskonzepten.

Rex

Das im Jahr 2021 von Julian Lechner und Jonathan Loesing gegründete Berliner Start-up Rex ist das aktuelle Paradebeispiel für moderne Tiermedizin. Rex kombiniert ein B2B/B2C-Hybrid-Modell und baut architektonisch anspruchsvolle, digital voll integrierte T Tierärzt*innenpraxen auf. Der USP liegt in der proprietären Praxismanagement-Software, die den Tierärzt*innen die Administration abnimmt, und der nahtlosen App-Experience für den Tierhalter. Das enorme Potenzial dieses Modells überzeugte Vorwerk Ventures, Picus Capital und weitere namhafte Investor*innen, die dem Unternehmen bereits zweistellige Millionenbeträge anvertrauten.

Filu

Ebenfalls angetreten, um den chronisch überlasteten Tierärzt*innenmarkt zu revolutionieren, ist das Münchner Start-up Filu. Gegründet 2022 von Anna Magdalena Naderer, Christian Köhler und Justus Buchen, positioniert sich das Unternehmen mit seinem Urgent-Care-Ansatz gekonnt zwischen klassischer Allgemeinpraxis und Notfallklinik. Die Kombination aus modernster Hardware vor Ort und smarten Tele-Triage-Prozessen im Hintergrund sorgt für eine extrem hohe Effizienz. Lead-Investoren wie DN Capital und YZR Capital haben das immense Skalierungspotenzial früh erkannt und die Expansionspläne befeuert.

mammaly

Im Bereich der D2C-Tiergesundheit setzt das 2020 in Köln von Stanislav Nazarenus und Alexander Thelen gegründete Start-up mammaly neue Standards. Das Geschäftsmodell basiert auf dem Direktvertrieb von hochwirksamen, mit Tierärzt*innen entwickelten Nahrungsergänzungsmitteln in Snackform. Der USP liegt in der tiefgreifenden Fokussierung auf das Mikrobiom von Hunden, um altersbedingte Beschwerden proaktiv zu lindern. Dieses datengetriebene und markenstarke Konzept sicherte mammaly unter anderem ein substanzielles Funding durch den spezialisierten VC Five Seasons Ventures.

PetLEO

Dieses 2020 in München von Karim Abdo und Bülent Hacioglu gegründete Unternehmen agiert als eine hochkomplexe B2B2C-Gesundheitsplattform. PetLEO verbindet Tierärzt*innen, Expert*innen und Haustierbesitzer*innen in einem geschlossenen, digitalen Ökosystem. Tierhalter*innen können Gesundheitsdaten verwalten, Giftköder-Warnungen erhalten und Termine buchen, während die Praxen selbst eine moderne Schnittstelle zur Kund*innenbindung erhalten. Das Start-up hat sich durch starke Partnerschaften mit Industrie und Versicherungen eine äußerst wehrhafte Marktposition als digitaler Alltagsbegleiter erarbeitet.

Hundeo

Dass man auch ohne massive externe Kapitalrunden im PetTech-Markt dominieren kann, beweist das 2020 von Enrico Bachmann in Berlin gegründete Start-up Hundeo. Das B2C-EdTech-Modell ist eine gamifizierte App für modernes Hundetraining. Der technologische USP ist die personalisierte, KI-gestützte Trainingsplanung, die sich dem Lernfortschritt des jeweiligen Tieres anpasst. Mit enormem organischem Wachstum und starker Nutzer*innenbindung gehört das gebootstrappte Hundeo zu den profitablen Vorzeige-Start-ups der App-Economy.

Nosh.bio

Obwohl nicht exklusiv für den Pet-Markt gegründet, rüttelt das 2022 von Tim Fronzek und Felipe Lino in Berlin ins Leben gerufene DeepTech-Start-up Nosh.bio die Tiernahrungsindustrie fundamental auf. Das B2B-Geschäftsmodell fokussiert sich auf die Herstellung von Alternativen Proteinen aus Pilzmyzel. Der technologische USP liegt in einem hocheffizienten Fermentationsprozess, der saubere, hochverdauliche und texturstarke Proteinquellen aus Pilzmyzel liefert. Als hochfunktionale „Clean-Label“-Zutat ermöglicht sie die Entwicklung erstklassiger, fleischfreier Tiernahrung – völlig ohne chemische Zusätze und ohne den massiven ökologischen Fußabdruck der konventionellen Fleischindustrie. Lead-Investor Earlybird unterstützt dieses zukunftsweisende BioTech-Modell.

TestBlu

Mit Gründung im Jahr 2022 in Potsdam bringt TestBlu echte Deep-Science in die tierärztliche Praxis. Das von Shahab Shoaei Matin geführte Geschäftsmodell ist ein KI-gestütztes B2B-SaaS-Produkt für Veterinärkliniken. Der USP des Unternehmens ist Deutschlands erster Bluttest zur Früherkennung von Krebs bei Hunden. Ein hochkomplexer Algorithmus analysiert Blutbilder auf Anomalien mit enormer Präzision. TestBlu positioniert sich als unverzichtbarer onkologischer Co-Pilot für Tierärzt*innen, um die diagnostische Sicherheit drastisch zu erhöhen.

AnimalChat

Die 2020 von Sebastian Wilkes und dem erfahrenen Tierarzt Dr. Heinrich Wilkes aus Borken gestartete B2B-Software AnimalChat hat das Problem der ineffizienten Kommunikation in Praxen radikal gelöst. Das Start-up bietet einen DSGVO-konformen, professionellen Messenger-Dienst speziell für Veterinär*innen und deren Klient*innen an. Der USP ist die nahtlose Integration von asynchroner Kommunikation und digitaler Wundverlaufskontrolle, ohne dass der Arzt bzw. die Tierärztin seine bestehende Praxissoftware austauschen muss. Dieses pragmatische, aber hochskalierbare Tool hat sich in hunderten Praxen als Standard etabliert.

Internationaler Ausblick & Fazit

Wer heute verstehen will, was morgen in Europa passiert, muss den Blick zwingend über den Tellerrand richten. Drei globale Makro-Trends werden den deutschen PetTech-Markt in Kürze massiv umwälzen. Aus den USA schwappt die Welle der Longevity-Pillen herüber, wo Start-ups bereits erste FDA-Zulassungen für Medikamente anstreben, die das biologische Altern von Hunden verlangsamen. Asien hingegen definiert den Standard für Hyper-Vernetzung neu: Hier sind smarte Katzentoiletten und vollautomatische, mit dem Smart-Home synchronisierte Futterautomaten, die Gesundheitsdaten in Echtzeit an den Tierarzt bzw. die -ärztin senden, bereits Massenmarkt. In Israel, dem weltweiten Hub für FoodTech, verschmilzt derweil AgriTech mit Tiernahrung. Kultiviertes Fleisch aus dem Labor für Premium-Tiernahrung steht dort nach der ersten regulatorischen Marktzulassung für Heimtierfutter in Großbritannien durch das Start-up Meatly endgültig vor dem globalen Durchbruch.

Das Fazit für 2026 ist eindeutig: Der Welpenschutz für Gründer*innen ist abgelaufen. PetTech ist ein knallhartes Business, das exzellente Unit Economics, tiefes regulatorisches Verständnis und echte technologische Alleinstellungsmerkmale verlangt. Investor*innen suchen heute nach Geschäftsmodellen, die reale Engpässe wie den Tierärzt*innenmangel lösen oder die Lebensspanne der Tiere durch harte Wissenschaft verlängern. Wer in diesem 20-Milliarden-Markt mitspielen will, muss beweisen, dass er/sie nicht nur Tiere liebt, sondern vor allem sein/ihr strategisches und technologisches Handwerk versteht.

Angriff auf die Giganten: Das Milliarden-Business mit dem „schnellen Teil“

Wie die SPAREPARTSNOW-Gründer Dr. Christian Hoffart und Sebastian Kleinschmager von München aus den Weltmarkt für Ersatzteile umkrempeln und US-Distributoren das Fürchten lehren wollen.

Ein defektes Bauteil, ein rauchendes Fließband und ein wirtschaftlicher Schaden von 100.000 Euro pro Tag: Der Albtraum eines jeden Werksleiters ist oft bittere Realität. Während der private Konsum längst im „Next-Day-Zeitalter“ angekommen ist, glich die Beschaffung von Industrieteilen bisher einer archäologischen Expedition durch verstaubte Fax-Listen und intransparente Händlerstrukturen. Das Münchner Start-up SPAREPARTSNOW beendet diese Ära nun endgültig und beweist, dass „DeepTech made in Germany“ das Zeug zur globalen Disruption hat.

Die Geburtsstunde einer Milliarden-Idee

Trotz Industrie 4.0 scheiterte der Maschinenbau bisher oft an einer simplen Hürde: der Ersatzteil-Logistik. Zwischen dem Originalhersteller (OEM) und dem Endkunden in den USA oder Asien lagen meist drei bis fünf Zwischenstationen. Jede dieser Stationen kostete wertvolle Zeit und schlug massive Margen auf das Produkt auf. Die Folge war ein absurdes Ungleichgewicht: Ein in Deutschland produziertes Bauteil kam im Ausland oft mit Wochen Verspätung und zum doppelten Preis an.

Hier setzten Dr. Christian Hoffart und Sebastian Kleinschmager im Jahr 2022 an. Ihre Vision war so simpel wie radikal: Die Disintermediation – das radikale Ausschalten des Zwischenhandels. SPAREPARTSNOW verbindet die Industrie-Giganten direkt mit den Fabrikhallen weltweit. Was 2022 mit 20.000 Artikeln begann, ist bis heute – im Februar 2026 – auf ein digitales Ökosystem von über 5 Millionen Ersatzteilen angewachsen.

Der technologische Kraftakt hinter dem Wachstum

Für StartingUp-Leser*innen ist besonders die Skalierung interessant. Von 20.000 auf 5 Millionen Teile zu wachsen, ist kein reiner Vertriebserfolg, sondern eine technologische Meisterleistung. Während Sebastian Kleinschmager im Hintergrund die KI-gestützten Identifikationsalgorithmen verfeinerte, die heute selbst unscharfe Fotos von Bauteilen in Millisekunden zuordnen, musste das Team die Datenhoheit der oft skeptischen OEMs gewinnen.

Strategischer Meilenstein: Frontalangriff auf Nordamerika

Im Februar 2026 steht SPAREPARTSNOW vor seinem bisher kühnsten Schritt: dem Markteintritt in Nordamerika. Die Strategie ist ein Frontalangriff auf etablierte US-Distributoren. Durch die direkte OEM-Anbindung bietet SPAREPARTSNOW europäische Top-Marken in den USA zu Preisen an, die 20 bis 50 Prozent unter dem bisherigen US-Marktniveau liegen. Der „Transatlantik-Express“ garantiert zudem, dass ein Bauteil aus Süddeutschland oft schon am nächsten Werktag in einer US-Fabrik eintrifft. Geschwindigkeit ist hier die einzige Währung, die gegen den drohenden Stillstand hilft.

München oder Silicon Valley?

Trotz der globalen Ambitionen bleibt SPAREPARTSNOW fest in der bayerischen Landeshauptstadt verwurzelt. In einer Welt, in der Start-ups oft schielten, sobald das erste Wagniskapital aus den USA winkte, blieb das Team dem Standort München treu. Hier sitzt die Kompetenz des Maschinenbaus, hier ist die Nähe zu den Herstellern – ein strategischer Vorteil, den kein Algorithmus der Welt ersetzen kann.

Die Zukunft der globalen Instandhaltung

Mit dem Rollout in den USA und dem geplanten Sprung nach Südostasien im dritten Quartal 2026 schließt sich der Kreis zu einem globalen Netzwerk. SPAREPARTSNOW beweist, dass Mut zur Lücke und technologische Tiefe ausreichen, um jahrzehntealte Monopole aufzubrechen. Durch die Kombination aus radikaler Preistransparenz, KI-gestützter Teilesuche und einer Logistik, die Kontinente in Stunden überbrückt, schafft das Unternehmen einen fundamentalen Fortschritt für die weltweite Industrie. In einer Zeit, in der Resilienz und Schnelligkeit über die Wettbewerbsfähigkeit ganzer Wirtschaftsstandorte entscheiden, wird SPAREPARTSNOW vom bloßen Marktplatz zum unverzichtbaren Rückgrat einer digitalisierten, globalen Produktion, die nicht nur schneller und günstiger, sondern durch die Integration von Refurbished-Teilen und reduzierten Lagerwegen auch nachhaltiger agiert.

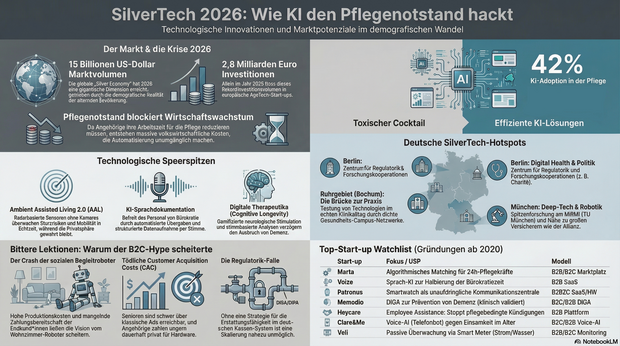

SilverTech-Start-up-Report 2026

Wie SilverTech-Start-ups 2026 den Pflegenotstand mit KI hacken. Der große Report inklusive unserer Top-Start-up-Watchlist.

Das Jahr 2026 markiert einen historischen Wendepunkt in der demografischen Realität Europas. Die stärksten Jahrgänge der Babyboomer verabschieden sich nun massenhaft in den Ruhestand. Was Soziolog*innen seit Jahrzehnten prophezeien, ist unerbittliche wirtschaftliche Realität geworden: Der Pflegenotstand ist kein dystopisches Zukunftsszenario mehr, sondern blockiert messbar das Wirtschaftswachstum, da Angehörige ihre Arbeitszeit drastisch reduzieren müssen, um klaffende Versorgungslücken zu schließen.

In diesem toxischen Cocktail aus Fachkräftemangel und Überalterung hat sich ein Sektor emanzipiert, der auf Pitch-Decks lange als völlig unsexy galt: SilverTech. Technologien für die alternde Weltbevölkerung, in der Start-up-Szene oft synonym als AgeTech bezeichnet, sind vom Nischenthema für wohlhabende Senior*innen zur systemrelevanten Überlebensstrategie unserer Gesellschaft mutiert. Wer heute den demografischen Wandel technologisch skaliert, baut nicht weniger als das Rückgrat der Gesundheitsversorgung von morgen.

Wenn KI den Pflegenotstand hackt

Der Markt für AgeTech hat seine experimentelle Phase endgültig hinter sich gelassen. Die globale „Silver Economy“ wird von Analyst*innen für das laufende Jahr auf ein gigantisches Volumen von rund 15 Billionen US-Dollar geschätzt. Allein der europäische Markt verzeichnete 2025 ein Rekord-Investitionsvolumen von knapp 2,8 Milliarden Euro für Start-ups in diesem Segment. Der absolute technologische Haupttreiber ist dabei künstliche Intelligenz, genauer gesagt die Konvergenz aus generativen Sprachmodellen und prädiktiver Analytik. Eine aktuelle Studie des Digitalverbands Bitkom belegt, dass bereits 42 Prozent der stationären Pflegeeinrichtungen in Deutschland KI-gestützte Systeme zur Entlastung des Personals testen oder flächendeckend einsetzen.

Auch die KfW-Research-Abteilung warnt in ihrem jüngsten Bericht eindringlich davor, dass ohne massive Investitionen in pflegeunterstützende Automatisierung die volkswirtschaftlichen Kosten der Überalterung untragbar werden. Wir sehen heute realistische Seed-Runden von 3 bis 5 Millionen Euro für Softwarelösungen, die nachweislich die sogenannte Time-to-Care – also die aktive Zeit am Menschen – signifikant erhöhen.

Innovationen jenseits des Notrufknopfs

Wer bei SilverTech immer noch an klobige rote Notruf-Armbänder denkt, verpasst die eigentliche Revolution. In diesem Jahr dominieren völlig neue Sub-Sektoren den Markt. An erster Stelle steht das Edge-AI-gestützte „Ambient Assisted Living 2.0“. Hierbei analysieren radargestützte Sensoren, die gänzlich ohne Kameras auskommen und somit die Privatsphäre wahren, das Sturzrisiko und die Mobilität in Echtzeit.

Ein weiterer dominanter Sektor ist die KI-gesteuerte Sprachdokumentation, die das Pflegepersonal von der erdrückenden Bürokratie befreit und Übergaben automatisiert.

Drittens sehen wir den enormen Aufstieg von digitalen Therapeutika für kognitive Langlebigkeit (Cognitive Longevity), die den Ausbruch von Demenz durch gamifizierte neurologische Stimulation und stimmbasierte Analysen verzögern. Pioniere, die diese Felder bereits vor Jahren besetzt haben und heute als etablierte Vorbilder gelten, sind etwa das belgische Scale-up Nobi mit seinen intelligenten Lampen zur Sturzerkennung oder das Berliner Unternehmen Lindera, das die Mobilitätsanalyse per regulärer Smartphone-Kamera revolutioniert hat.

Die B2C-Hardware-Falle und bittere Lektionen

Doch der Weg zur Marktreife war gepflastert mit verbrannten Millionen. Der größte Hype der frühen 2020er Jahre war die Vision des autarken, sozialen Begleitroboters für das heimische Wohnzimmer. Zahlreiche Start-ups versuchten, süße, sprechende Hardware-Kompagnons als Waffe gegen die Einsamkeit im Alter direkt an den Endkunden / die Endkundin zu verkaufen. Dieser Markt crashte krachend. Unternehmen scheiterten reihenweise an den horrenden Produktionskosten und einer eklatant mangelnden Zahlungsbereitschaft der Zielgruppe.

Aus diesen gescheiterten Hoffnungen lassen sich für heutige Gründer*innen vier fatale Fallstricke ableiten. Der erste Fehler ist die tödliche Customer Acquisition Cost (CAC) im B2C-Geschäft. Senioren werden nicht über Instagram-Ads konvertiert, und die erwachsenen Kinder zahlen ungern dauerhaft aus eigener Tasche. Die zweite Lektion dreht sich exakt um die Regulatorik: Wer die Erstattungsfähigkeit über das System der Digitalen Pflegeanwendungen (DiPA) oder Gesundheitsanwendungen (DiGA) nicht von Tag eins an strategisch mitdenkt, skaliert niemals im strengen deutschen Kassen-System. Der dritte Stolperstein ist das verhängnisvolle Over-Engineering. Gründer*innen neigen oft dazu, maximale Feature-Vielfalt zu bauen, statt absolute Barrierefreiheit und Usability für eine Zielgruppe mit nachlassenden sensorischen Fähigkeiten in den Fokus zu rücken. Die vierte und finale Lektion lautet: Hardware is hard. Wer komplexe physische Produkte baut, statt sich auf margenstarke B2B-SaaS-Lösungen für Pflegeheime oder ambulante Dienste zu konzentrieren, benötigt einen extrem langen Atem, den kaum ein europäischer VC heute noch ohne weiteres finanziert.

Wo die Silver Economy geschmiedet wird