Aktuelle Events

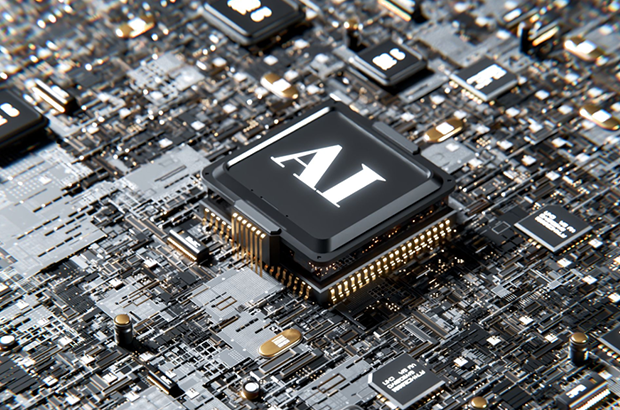

Wie KI-Technologie den modernen Arbeitsalltag revolutioniert

Die dritte Phase der Digitalisierung hat begonnen. Wir zeigen Anwendungsgebiete und Potenziale moderner KI-Technologien im Überblick.

Der moderne Büroalltag, aber auch die Unternehmensführung, die Logistik, Marketing- und Planungsprozesse aller Art sind in den vergangenen Jahrzehnten immer digitaler und rationaler geworden. Derzeit befinden wir uns mitten in einem weiteren Umbruchsprozess, der in seiner Wirkung nur mit der Einführung des PCs und der umfassenden Vernetzung durch Internet und Unternehmensnetzwerke vergleichbar sein dürfte.

Wie in Transformationsphasen üblich bringen diese entscheidende Risiken und Potenziale für etablierte Größen wie auch für Start-ups mit sich. Wer jetzt zurückbleibt, verschafft der Konkurrenz unter Umständen einen Vorsprung, der nur schwer einholbar sein kann. Umgekehrt bieten sich für frühe Anwender zahlreiche Chancen, die eigenen Prozesse zu rationalisieren, neue Dienstleistungen auf den Markt zu bringen und sich auf absehbare Zeit eine stabile Marktposition zu erobern.

Um das volle Potenzial der digitalen Revolution und insbesondere der sich rasant entwickelnden KI-Technologie ausloten zu können, sollte man sich zunächst bewusst machen, welche Bedeutung technische Revolutionen auf den Arbeits- und Unternehmensalltag haben, sich einen möglichst breiten Überblick über die verschiedenen Anwendungsmöglichkeiten der neuen Technologie verschaffen und sich abschließend fragen, wie das eigene Unternehmen oder ein vielversprechendes Businessmodell davon profitieren könnten.

Die drei Phasen der digitalen Revolution

Einfach nur von der digitalen Revolution zu sprechen, wird dem Phänomen längst nicht mehr gerecht. Eine Einteilung in drei historische Phasen zeigt einerseits, wie lange wir bereits von der computergetriebenen Entwicklung beeinflusst werden und andererseits, wie sich die Digitalisierung zunehmend in alle ökonomischen und sozialen Bereiche ausdehnt.

1. Die Ära des Personal Computers: Die Anfänge der digitalen Revolution

Die erste Phase der digitalen Revolution begann mit der Einführung des Personal Computers in den Büroalltag. Dieser technologische Durchbruch in den 1970er und 80er Jahren markierte einen Paradigmenwechsel in der Arbeitswelt. PCs ermöglichten eine effizientere Datenverarbeitung, Textverarbeitung und Tabellenkalkulation, wodurch zeitaufwendige manuelle Prozesse ersetzt wurden. Diese Entwicklung ebnete den Weg für eine produktivere und zugänglichere Arbeitsumgebung, in der Aufgaben schneller und präziser ausgeführt werden konnten.

2. Das Internetzeitalter: Vernetzung und globale Expansion

Die zweite Phase, ausgelöst durch die weite Verbreitung des Internets in den 1990er Jahren, revolutionierte die Kommunikation und Zusammenarbeit im Büro. Die Möglichkeit, in Echtzeit Informationen auszutauschen und auf eine Fülle von Online-Ressourcen zuzugreifen, eröffnete Unternehmen neue Dimensionen der globalen Vernetzung. E-Mail wurde zum Standardkommunikationsmittel, während das World Wide Web eine Plattform für unendliche Informations- und Geschäftsmöglichkeiten wurde. Diese Ära definierte die Art und Weise, wie Unternehmen operieren und interagieren, vollständig neu und leitete das Zeitalter der digitalen Wirtschaft ein.

3. KI-Technologie: Ein neues Kapitel in Produktion, Unternehmensführung, Vermarktung und Verwaltung

In der dritten und aktuellen Phase der digitalen Revolution tritt KI in den Vordergrund, indem sie die Grenzen praktisch aller unternehmerischen Prozesse und den Büroalltag von Millionen Menschen neu definiert. KI-gesteuerte Anwendungen, von automatisierten Kundendienstlösungen bis hin zu fortschrittlicher Datenanalytik, transformieren die Arbeitsweise in Unternehmen grundlegend. Sie ermöglichen nicht nur eine bisher unerreichte Automatisierung und Effizienzsteigerung, sondern auch eine personalisierte und vorausschauende Geschäftsstrategie in allen Bereichen von der Vermarktung bis zu den Lieferketten. Die Integration von KI in den modernen Unternehmensalltag stellt somit nicht nur eine Fortsetzung der Digitalisierung dar, sondern eröffnet neue Wege in Richtung intelligenter, datengesteuerter Arbeitsumgebungen in allen Unternehmensbereichen.

Potenziale und Anwendungsgebiete moderne KI-Techniken

Während die automatisierte Datenanalyse riesiger Datenmengen (Big Data) praktisch alle datengetriebenen Prozesse der Unternehmensführung, -organisation und Verwaltung betrifft, beginnt die jüngste Entwicklung sprachbegabter KI-Technologien gerade erst ihr Potenzial und ihre verschiedenen Anwendungsmöglichkeiten zu zeigen.

Verarbeitung natürlicher Sprache (NLP): KI, die uns versteht

Die Verarbeitung natürlicher Sprache (Natural Language Processing, NLP) ist ein beeindruckender technischer Durchbruch sowie ein faszinierendes und schnell wachsendes Feld der Künstlichen Intelligenz. Erstmals wird die Interaktion zwischen Computern und Menschen in natürlicher Sprache ermöglicht. Dies verschafft einer breiten Zahl von Nutzern Zugang zu Instrumenten, die zuvor nur Programmierern oder anderen Experten zur Verfügung standen. In Verbindung mit weiteren Fähigkeiten der KI lässt sich derzeit kaum eine Grenze für das Transformationspotenzial dieser Technologien erahnen. Im Kontext des modernen Büroalltags machen NLP-Anwendung beinahe täglich bedeutende Fortschritte und bieten immer vielfältigere Anwendungsmöglichkeiten, die die Arbeitsweise grundlegend verändern:

- Spracherkennung und -verarbeitung: NLP ermöglicht es Computern, gesprochene Sprache zu verstehen und zu verarbeiten. Dies erweitert die Interaktionsmöglichkeiten zwischen normalen Nutzern und KI-Anwendungen grundlegend. Eine der aktuellsten Innovationen auf diesem Gebiet ist beispielsweise Blizo, eine Software zur Transkription und übersichtlichen Zusammenfassung von Meetings. Anwendungen wie diese erlauben Mitarbeitern zudem Berichte durch Sprechen, anstatt durch Tippen zu erstellen, was Zeit spart und die Zugänglichkeit erhöht. NLP revolutioniert allgemein und umfassend die Sprachsteuerung von Geräten und Software, wobei die Entwicklung hier noch ganz am Anfang ist und die Möglichkeiten weiterer Anwendungen gerade erst am Horizont erscheinen.

- Chatbots und Virtuelle Assistenten: Im Kundenservice werden bereits seit längerer Zeit NLP-basierte Chatbots eingesetzt, um Kundenanfragen effizient zu beantworten oder vorzusortieren. Diese Systeme können natürliche Konversationen simulieren und so die Kundeninteraktion verbessern. Ebenso unterstützen virtuelle Assistenten Mitarbeiter, indem sie einfache Aufgaben wie die Terminplanung oder Informationsabfragen übernehmen. Alexa, Siri und Co. werden in Kürze wie fossile Urgesteine neben der neuesten Generation sprechender Bots aussehen und vermutlich bald selbst ein umfassendes Update bekommen.

- Sentimentanalyse: NLP-Tools können Stimmungen und Meinungen in Texten erkennen und analysieren. Dies ist besonders nützlich für Marketing- und Kundendienstabteilungen, um Kundenfeedback und Markttrends zu verstehen und darauf zu reagieren, kann beispielsweise aber auch in der Wissenschaft Anwendung finden.

- Automatische Zusammenfassungen und Berichterstattung: NLP kann genutzt werden, um lange Dokumente oder Datenmengen automatisch zu analysieren und zusammenzufassen. Dies spart Zeit bei der Informationsbeschaffung und ermöglicht es, schneller fundierte Entscheidungen zu treffen. NLP ermöglicht es Computern erstmals, menschliche Sprache in für sie prozessierbare Daten zu verwandeln.

- Sprachübersetzung: Fortgeschrittene NLP-Systeme bieten nahezu Echtzeit-Übersetzung von und in verschiedene Sprachen, was die globale Kommunikation und Zusammenarbeit erleichtert. ChatGPT etwa brachte sich selbst auf der Basis seiner Algorithmen und der englischen Sprache zahlreiche weitere Sprachen bei und kann mittlerweile für viele Sprachen auch als relativ zuverlässiges Übersetzungstool genutzt werden.

- Verbesserte Suchfunktionen: NLP verbessert Suchalgorithmen, sodass Nutzer natürliche Sprache verwenden können, um komplexe und kontextbezogene Informationen in Datenbanken oder im Internet zu finden. Dies wird die Forschung und Bildung in den nächsten Jahren transformieren und Big Data noch größer machen.

Alles kann berechnet werden: Big Data

Neben den Fortschritten bei der Sprachfähigkeit beeindrucken KI-Anwendungen vor allem durch ihre unglaublichen Analysefähigkeiten, mit denen sie in der Lage sind, verschiedenste Muster auf der Grundlage riesiger Datenmengen zu erstellen und sogar Vorhersagen über zukünftige Entwicklungen zu erstellen. Dabei speist sich die Datengrundlage, Big Data, aus unterschiedlichen Quellen von Social Media Postings bis hin zu medizinischen Statistiken und Ähnlichem.

Intelligente Algorithmen beziehungsweise Methoden des maschinellen Lernens ermöglichen eine automatisierte Analyse dieser Daten zu unterschiedlichen Zwecken. Aufgrund ihrer enormen Rechenleistung und der Fortschrittlichkeit der statistischen Analysemethoden entdecken KI-Anwendungen mittlerweile viele Muster zuverlässiger und schneller als menschliche Forscher oder Analysten. Über kurz oder lang wird ein Großteil unseres statistischen Wissens auf der automatisierten Analyse von Big Data beruhen. Zu den Hauptanwendungsgebieten dieser mächtigen Algorithmen gehören derzeit folgende Bereiche:

- Unternehmensorganisation und Entscheidungsfindung: Unternehmen nutzen Big Data, um Markttrends zu analysieren, Kundenverhalten zu verstehen und fundierte Entscheidungen bei Geschäftsstrategien, in der Produktentwicklung und bezüglich ihrer Marketingkampagnen zu treffen. Diese Analysen ermöglichen es Unternehmen, auf sich ändernde Marktdynamiken schnell zu reagieren und ihre Angebote besser auf die Kundenbedürfnisse abzustimmen.

- Personalisierte Kundenerfahrungen: Im Einzelhandel und in der Dienstleistungsbranche wird Big Data verwendet, um personalisierte Einkaufserlebnisse zu schaffen. Durch Analyse des Kaufverhaltens, Online-Interaktionen und Kundenpräferenzen können Unternehmen individuell zugeschnittene Empfehlungen und Angebote erstellen.

- Gesundheitswesen: Im Gesundheitssektor ermöglichen Big Data Analysen eine bessere Patientenversorgung durch die Analyse von Patientendaten, klinischen Studien und Forschungsergebnissen. Sie tragen zur Entwicklung personalisierter Medizin bei und helfen bei der Vorhersage von Krankheitsmustern und Epidemien.

- Finanzdienstleistungen: In der Finanzbranche wird Big Data unter anderem genutzt, um Risiken zu bewerten, Betrug zu erkennen und Investitionsentscheidungen zu optimieren. Banken und Versicherungen analysieren große Mengen an Transaktionsdaten, um ungewöhnliche Muster zu identifizieren und ihr Risikomanagement zu verbessern.

- Supply Chain Management: Big Data hilft Unternehmen, ihre Lieferketten effizienter zu gestalten. Durch die Analyse von Daten aus verschiedenen Quellen können Unternehmen Lagerbestände optimieren, Lieferzeiten verkürzen und die Reaktionsfähigkeit auf Marktveränderungen verbessern.

- Städtische Planung und Verkehr: Im öffentlichen Sektor werden Big Data Anwendungen zur Verbesserung der städtischen Infrastruktur und zur Optimierung des Verkehrsflusses eingesetzt. Städte nutzen Verkehrs- und Mobilitätsdaten, um Staus zu reduzieren und öffentliche Dienstleistungen zu verbessern.

- Energie und Umwelt: Im Energiebereich ermöglichen Big Data Analysen eine effizientere Nutzung von Ressourcen und tragen zur Entwicklung nachhaltiger Energielösungen bei. Sie werden auch zur Überwachung und zum Schutz der Umwelt eingesetzt, indem beispielsweise Emissionsdaten analysiert werden.

Fazit: Unendliche Möglichkeiten

Wie in der Übersicht deutlich geworden sein dürfte, sind die Möglichkeiten und Grenzen moderner KI-Technologien derzeit kaum absehbar. Nahezu jede Branche sowie Unternehmen aller Größen werden in den nächsten Jahren in der ein oder anderen Form durch diese neueste Phase der digitalen Revolution beeinflusst werden. Derzeit stecken viele Anwendungen zwar noch in den Kinderschuhen, aber ihr Transformations- und Rationalisierungspotenzial lässt sich bereits erahnen – und vor allem schon heute nutzen.

Jeder Jungunternehmer, Start-up-Gründer, aber auch etablierte Firmen und Manager sollten diese frühe Phase nutzen, um sich einen Vorsprung zu verschaffen, Erfahrungen zu sammeln und ihr gesamtes Geschäftsmodell daraufhin zu befragen, wo ihnen KI in Zukunft behilflich sein kann.

Diese Artikel könnten Sie auch interessieren:

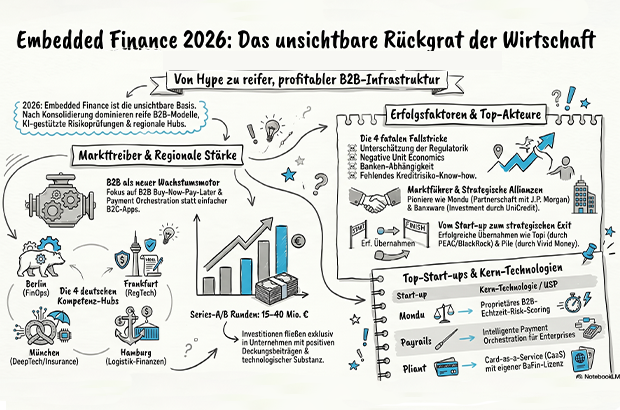

Embedded-Finance-Start-up-Report 2026

Der unsichtbare Bankensektor: Wie Embedded Finance und die dazugehörigen Start-ups die Wirtschaft des Jahres 2026 prägen.

Einst war es das große Versprechen für eine Handvoll hipper Neobanken, heute ist es das unsichtbare Rückgrat der europäischen Wirtschaft: Embedded Finance. Im Jahr 2026 wird das Marktwachstum längst nicht mehr von der fixen Idee isolierter Bank-Apps dominiert, denn jedes zukunftsorientierte Unternehmen ist mittlerweile selbst zu einem/einer Finanzdienstleister*in geworden. Ob Software-as-a-Service-Anbieter*in, Logistik-Plattform oder Marktplatz – die nahtlose Integration von Zahlungen, Krediten und Versicherungen in nicht-finanzielle Kund*innenreisen ist das neue Paradigma.

Dieser Report beleuchtet eine Branche, die den „Sturm der Konsolidierung“ überlebt hat und nun mit reifen Geschäftsmodellen und echten Profiten die Architektur der modernen Wirtschaft neu programmiert.

Vom Hype zur fundamentalen Reife

Nach den massiven Zinsanpassungen und regulatorischen Aufräumarbeiten der Jahre 2023 und 2024 zeichnet der Embedded-Finance-Markt heute ein Bild robuster Reife. Renommierte Analystenhäuser wie Bain & Company und Dealroom haben diese Entwicklung früh vorgezeichnet: Der globale Markt für Embedded-Finance-Dienstleistungen hat sich in ein Multimilliarden-Segment verwandelt, dessen europäisches Transaktionsvolumen mittlerweile signifikante Teile des digitalen B2B- und B2C-Handels stützt. Der technologische Haupttreiber dieser neuen Ära ist unbestreitbar die künstliche Intelligenz, genauer gesagt proprietäre Machine-Learning-Modelle, die Risikobewertungen in Millisekunden durchführen und Transaktionsströme dynamisch optimieren. Investor*innen honorieren diese technologische Tiefe: Wir sehen heute höchst realistische Series-A- und Series-B-Runden im Bereich von 15 bis 40 Millionen Euro für Start-ups, die nachweislich positive Deckungsbeiträge aufweisen. Es fließt wieder signifikant Kapital, doch es fließt exklusiv in Substanz und Skalierbarkeit, nicht mehr in reines Marketing.

Die neuen Treiber: B2B, Vertikalisierung und Orchestrierung

Wenn man über das Offensichtliche wie einfache White-Label-Kreditkarten hinausblickt, dominieren im Jahr 2026 drei spezifische Sub-Sektoren den Markt. Allen voran steht B2B Buy-Now-Pay-Later, eine Disziplin, die das traditionelle, schwerfällige Factoring abgelöst hat und nun direkt in B2B-Checkouts und Beschaffungsnetzwerke integriert ist. Ein weiterer massiver Treiber ist die sogenannte Payment Orchestration für vertikale SaaS-Lösungen. Hier werden komplexe, branchenspezifische Zahlungsflüsse – etwa im Handwerk oder in der Gastronomie – automatisiert im Hintergrund abgewickelt. Zuletzt etabliert sich Embedded Insurance zunehmend im Industriekontext, wo Maschinen nicht mehr nur geleast, sondern im selben Atemzug transaktionsbasiert versichert werden. Pioniere wie die Berliner Mondu oder auch europäische Schwergewichte wie Swan haben den Weg für diese hochspezialisierten Infrastruktur-Layer geebnet und gezeigt, wie tiefgreifend diese Geschäftsmodelle in die Wertschöpfungsketten der Realwirtschaft eingreifen.

Die Lektionen der BaaS-Krise

Doch dieser Reifegrad wurde teuer erkauft. Der Beinahe-Kollaps des britischen Banking-as-a-Service-Pioniers Railsr und die drastischen BaFin-Sonderprüfungen samt Wachstumsbeschränkungen bei etablierten deutschen Playern wie Solaris in den Jahren zuvor haben den Markt fundamental erschüttert. Der Traum, Finanzdienstleistungen wie einfache Legosteine zusammenzustecken, kollidierte brutal mit der harten Realität des Bankwesens.

Aus diesen gescheiterten Hoffnungen lassen sich für heutige Gründer*innen vier konkrete, fatale Fallstricke ableiten. Der erste und wichtigste ist die eklatante Unterschätzung der Regulatorik; Compliance lässt sich nicht auslagern, und Aufsichtsbehörden dulden keine agilen Versuch-und-Irrtum-Prozesse bei der Geldwäscheprävention. Der zweite Fallstrick ist die Falle der negativen Unit Economics im B2C-Sektor, wo exorbitante Kund*innenakquisitionskosten oft nur durch kontinuierliches VC-Geld gedeckt wurden. Drittens das Klumpenrisiko der Abhängigkeit von einer einzigen Partnerbank, deren Ausfall das eigene Start-up über Nacht handlungsunfähig macht. Und viertens die Fehlannahme, dass Technologie allein ausreicht; wer heute kein tiefes Verständnis für klassisches Bilanzstruktur- und Kreditrisikomanagement mitbringt, scheitert unweigerlich.

Das deutsche Netzwerk: Die Schmieden der Infrastruktur

Deutschland hat sich in dieser Konsolidierungsphase als einer der resilientesten Standorte in Europa bewiesen, getragen von vier essenziellen Hubs. Berlin verteidigt dabei seinen Status als unangefochtene Hauptstadt für FinOps und B2B-Zahlungsinfrastruktur, massiv befeuert durch die Talent-Pipelines der TU Berlin sowie das dichte Netzwerk an Serial Entrepreneurs aus der N26- und SumUp-Schule. Frankfurt am Main bildet den unverzichtbaren regulatorischen Gegenpol; hier, im Schatten von EZB und BaFin, entstehen im Umfeld des TechQuartiers und der Frankfurt School of Finance and Management jene Start-ups, die komplexe Compliance- und Treasury-Architekturen für Großbanken bauen. München dominiert den Bereich DeepTech und Embedded Insurance im industriellen B2B-Kontext, was auf die herausragende Stellung des Center for Digital Technology and Management (CDTM) und die enge Verzahnung mit der ansässigen Versicherungs- und Automobilindustrie zurückzuführen ist. Hamburg schließlich hat sich als europäischer Hotspot für Trade Finance und in Logistikketten eingebettete Finanzierungen etabliert, gestützt durch die traditionelle Stärke der Hansestadt im globalen Handel.

Investor*innen-Radar

Das Ökosystem der Geldgeber*innen hat sich im Jahr 2026 stark differenziert und professionalisiert. An der Spitze der spezialisierten VCs agieren Fonds wie FinTech Collective und Motive Ventures (hervorgegangen aus der Übernahme des Berliner VCs embedded/capital), die mit tiefem technologischen Verständnis gezielt in Infrastruktur-Layer investieren. Unter den Top-Tier Generalisten ragen Cherry Ventures, Earlybird und Point Nine heraus, die insbesondere Series-A-Runden bei überzeugenden B2B-SaaS-Modellen anführen.

Ein starker Motor sind zudem Corporate VCs und bankennahe Fonds geworden: CommerzVentures, als unabhängiger Player, treibt Themen wie Climate-Fintech massiv voran, während CVCs der Realwirtschaft wie Allianz X und Porsche Ventures strategisch in Start-ups investieren, die sich nahtlos in ihre eigenen vertikalen Ökosysteme einklinken lassen. In der kritischen Frühphase wird der Markt von einer hochgradig vernetzten Gruppe aus Business Angels angetrieben, die nicht nur erstes Kapital, sondern vor allem regulatorisches Know-how und entscheidende Bankennetzwerke einbringen

Die Top Start-ups (Must-Watch)

Für die nachfolgende Liste der Must-Watch-Unternehmen haben wir strikte Kriterien angelegt. Die Auswahl basiert auf nachgewiesener Marktrelevanz durch echte Kund*innenimplementierungen, einem hohen technologischen Reifegrad und einem diversifizierten Ansatz bei der Lösung komplexer Finanzinfrastrukturprobleme. Zudem war ein nachhaltiges Investoren-Vertrauen in den letzten zwölf Monaten ein Schlüsselfaktor. Wir beleuchten hierbei ausschließlich Start-ups mit Hauptsitz in Deutschland, deren Gründung im Jahr 2020 oder später erfolgte, um die wahre nächste Generation der Branche abzubilden.

Banxware

Das 2020 von Miriam Wohlfarth und Jens Röhrborn gegründete Banxware hat sich als Marktführer für Embedded Lending in Deutschland etabliert. Banxware bietet eine White-Label-Lösung, mit der Marktplätze und Zahlungsdienstleister*innen ihren Händler*innen Sofortkredite basierend auf historischen Umsatzdaten anbieten können. Der USP liegt in der extrem schnellen Risikoprüfung und der nahtlosen API-Integration in bestehende Plattformen. Das enorme Vertrauen der Finanzbranche in dieses Modell spiegelt sich massiv auf Investor*innenseite wider: Neben frühen Leadern wie Element Ventures (heute 13books Capital) ist insbesondere der Einstieg der Großbank UniCredit ein Ritterschlag. Die Bank führte nicht nur die Series-A-Runde an, sondern legte Mitte 2025 mit einem weiteren strategischen Millionen-Investment nach, um die europäische Expansion von Banxware gemeinsam voranzutreiben.

Pliant

Im Jahr 2020 von Malte Rau und Fabian Terner aus der Taufe gehoben, definiert Pliant den Markt für B2B-Kreditkarten und Ausgabenmanagement neu. Das B2B-SaaS-Modell kombiniert eine moderne Karteninfrastruktur mit einer tiefen API-basierten Integration in Buchhaltungs- und ERP-Systeme. Der technologische Vorsprung liegt im eigenen Card-as-a-Service-Angebot (CaaS), das anderen B2B-Plattformen den Launch eigener Kreditkartenprogramme ermöglicht. Ein entscheidender Meilenstein war hierfür der Erhalt der eigenen E-Geld-Lizenz der BaFin, die Pliant die nötige regulatorische Unabhängigkeit verleiht. Unterstützt wird Pliant von namhaften Investoren wie SBI Investment, Alstin Capital – und einem Investment des globalen Schwergewichts PayPal Ventures, das das enorme Skalierungspotenzial der Plattform bestätigt.

Mondu

Die Serial Entrepreneurs Malte Huffmann, Philipp Povel und Gil Danziger gründeten Mondu 2021 und revolutionieren damit den B2B-Zahlungsverkehr. Ihr B2B-BNPL-Modell ermöglicht es Geschäftskund*innen, online wie B2C-Kund*innen auf Rechnung oder in Raten zu kaufen, während der Händler sofort sein Geld erhält. Die Kerntechnologie ist ein proprietäres Echtzeit-Risk-Scoring für Firmenkund*innen. Finanziert wurde diese Vision anfangs von Top-Tier-Fonds wie Valar Ventures und Cherry Ventures. Der ultimative Ritterschlag erfolgte jedoch Ende 2025: Neben dem Erhalt der E-Geld-Lizenz sicherte sich Mondu eine 100-Millionen-Euro-Fazilität von J.P. Morgan Payments inklusive einer strategischen Partnerschaft, um die Buy-Now-Pay-Later-Lösung dem europäischen Kund*innen stamm der US-Großbank anzubieten.

Payrails

Gegründet 2021 von Orkhan Abdullayev, Emre Talay und Nicolas Thouzeau, löst Payrails die Herausforderung der Payment Orchestration. Das FinOps-Start-up baut ein intelligentes Betriebssystem für Zahlungen, das Transaktionen für Enterprise-Kund*innen dynamisch über verschiedene Provider routet, um Kosten zu senken und Autorisierungsraten zu maximieren. Die technologische Brillanz dieser Architektur lockte früh Schwergewichte wie Andreessen Horowitz und EQT Ventures an. Im Sommer 2025 zündete Payrails die nächste Stufe: HV Capital führte eine massive Series-A-Runde über 32 Millionen US-Dollar an, bei der auch alle Top-Tier-Altinvestoren erneut mitzogen, um die globale Expansion der Plattform endgültig zu sichern.

Finmid

Die beiden N26-Alumni Max Schertel und Alexander Talkanitsa starteten Finmid 2021 mit der Mission, jede B2B-Plattform zu einer Finanzierungsquelle zu machen. Ihr Geschäftsmodell fokussiert sich auf Embedded B2B Lending, das speziell auf die Anforderungen von Marktplätzen (wie etwa dem Partner Wolt) zugeschnitten ist – ohne dass diese Plattformen eigenes Kapital bereitstellen oder Risiken tragen müssen. Ihr USP ist die radikale Simplifizierung der B2B-Kreditvergabe durch smarte Echtzeit-Datenverknüpfungen. Angetrieben von einer wuchtigen 23-Millionen-Euro-Series-A-Runde, angeführt vom britischen Fonds Blossom Capital und dem Seed-Lead Earlybird, treibt das Start-up seine aggressive europäische Expansion unaufhaltsam voran.

Topi (Exit)

Charlotte Pallua und Estelle Merle brachten Topi 2021 an den Start, um das Hardware-as-a-Service-Modell in den B2B-Bereich zu integrieren. Über die Plattform können B2B-Kund*innen IT-Equipment flexibel mieten, wobei Topi den gesamten Prozess vom Checkout über das Refinancing bis zum Asset-Management abwickelt. Nachdem Topi mit Händler*innen wie Cyberport massiv skalierte und von Top-VCs wie Index Ventures und Creandum finanziert wurde, erfolgte im Sommer 2025 der strategische Exit: Das FinTech wurde von dem internationalen Leasing-Giganten PEAC Solutions (einem BlackRock-Portfoliounternehmen) übernommen, um das innovative B2B-Mietmodell global in dessen gewaltige Finanzierungsinfrastruktur einzugliedern.

Hakuna

Im Bereich Embedded Insurance schlägt das 2021 von Sebastian Jost, Rupert Mayer und Orhan Köroglu gegründete Hakuna neue Wege ein. Das Start-up bietet Händler*innen eine Plattform für Garantieverlängerungen und Produktschutzversicherungen, nahtlos integriert in den Online- und Offline-Checkout. Der USP ist ein völlig neu gedachtes, digitales Schadensmanagement, das die Abwicklung für Endkund*innen radikal vereinfacht. Finanziert von Top-VCs wie Earlybird und Visionaries Club, hat Hakuna mittlerweile den Sprung ins absolute Enterprise-Segment geschafft: Im Jahr 2025 integrierten Branchenriesen wie Vorwerk, STIHL und Mister Spex die Embedded-Technologie des Start-ups, um ihre eigenen, maßgeschneiderten Produktschutzprogramme europaweit zu skalieren.

Pile (Exit)

Jessica Holzbach startete Pile 2022 und pivotierte das Modell nach dem Krypto-Winter erfolgreich zu einem hochspezialisierten Treasury-Angebot für Start-ups. Die B2B-SaaS-Technologie bündelte Konten und automatisierte die Diversifikation von Einlagen zur Risikominimierung. Das Modell erregte schnell Aufmerksamkeit und führte bereits im Sommer 2024 zu einem frühen Exit: Die 2019 gegründete Berliner Neobank Vivid Money übernahm das Start-up, um das eigene Business-Banking-Angebot mit Piles Treasury-Technologie aufzurüsten – ein Paradebeispiel für die rasante Konsolidierung im FinTech-Infrastrukturmarkt.

Internationaler Ausblick & Fazit

Blickt man über die Grenzen Europas hinaus, formen sich 2026 drei gewaltige Makro-Trends, die den deutschen Markt unausweichlich verändern werden. Aus Asien schwappt die Architektur für grenzüberschreitende Echtzeit-Settlements basierend auf regulierten Stablecoins und digitalen Zentralbankwährungen heran, was das traditionelle Korrespondenzbankensystem massiv unter Druck setzt. Die USA hingegen dominieren die Entwicklung der KI-gesteuerten autonomen Finanzen, bei der das Corporate Treasury von Algorithmen gesteuert wird, die ohne menschliches Zutun Liquidität verschieben. Aus Indien lernen wir, wie Identity-as-a-Service untrennbar mit dem Zahlungsverkehr verschmilzt und Betrug nahezu ausmerzt.

Für Gründer*innen und Investor*innen im DACH-Raum bedeutet dies: Der Fokus muss radikal auf Profitabilität, wasserdichter Compliance und extrem stabiler Infrastruktur liegen. Wer heute in Embedded Finance gewinnt, baut keine bunten Apps mehr, sondern die hochkomplexen, unsichtbaren Stahlträger der digitalen Weltwirtschaft.

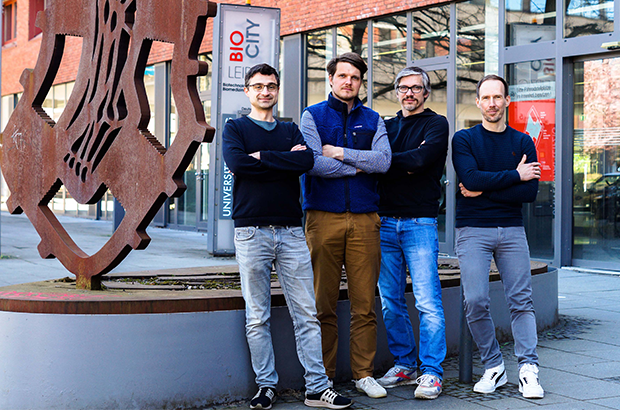

ESTER Biotech: Vom Friedhofskompost zur Plastik-Revolution

Ein Enzym vom Leipziger Südfriedhof soll das weltweite Plastikproblem lösen. Das 2025 als Uni-Spin-off gegründete Start-up ESTER Biotech verspricht, schwer recycelbares PET in Rekordzeit in seine Grundbausteine zu zerlegen. Doch auf dem Weg vom Labor in die industrielle Skalierung warten das berüchtigte „Valley of Death“ – und ein scheinbar übermächtiger Konkurrent.

Der Ursprung einer potenziellen industriellen Revolution liegt ausgerechnet auf einem Komposthaufen des Leipziger Südfriedhofs. Hier suchten Forschende der Universität Leipzig gezielt nach Mikroorganismen zur Zersetzung pflanzlicher Biopolymere und stießen auf das Enzym PHL7. Was in vielbeachteten Publikationen begann, mündete im Frühjahr 2025 in der offiziellen Ausgründung der ESTER Biotech GmbH.

Das Gründer-Quartett um die Geschäftsführer Dr. Ronny Frank und Martin Hirschfeld, den wissenschaftlichen Kopf Dr. Christian Sonnendecker (der das Enzym maßgeblich mitentdeckte) sowie den verfahrenstechnischen Leiter Madalin Ceausescu hat ein klares Ziel: das chemisch-biologische Recycling von Kunststoffen auf ein neues Level zu heben. Möglich machte diesen Schritt eine millionenschwere exist-Forschungstransfer-Förderung.

Für klassische Investor*innen sei die frühe Laborphase technologisch meist noch zu riskant, erklärt Christian Sonnendecker. Genau hier setzte das Programm an: „Der exist-Forschungstransfer hat für uns die Lücke zwischen akademischem Proof-of-Concept und einem investierbaren DeepTech-Start-up geschlossen“, betont der Gründer. „Wir konnten den Recyclingprozess vom Labormaßstab von einem Liter auf 100 Liter skalieren, neue Konzepte realisieren und das Verfahren validieren.“

Was passiert im Bioreaktor mit schmutzigem Müll?

Das technologische Versprechen ist enorm: Das modifizierte Enzym zerlegt selbst schwer recycelbares PET – wie Multilayer-Verpackungen – bei moderaten 65 Grad Celsius und Reaktionszeiten von unter 6 Stunden. Daraus kann neuwertiges, lebensmittelechtes Plastik entstehen. Doch wie reagiert das System in der Realität auf stark kontaminierten Haushaltsmüll? „Wir haben bislang keinen echten Show-Stopper gesehen“, sagt Sonnendecker pragmatisch. Er verzichtet auf romantische Labor-Illusionen und ordnet die Fakten nüchtern ein: „Enzyme gelten als empfindlich, aber in der Praxis arbeiten sie erstaunlich resilient. In den typischen Abfallfraktionen, die wir getestet haben, führen Störstoffe aus Haushaltsverpackungen nicht zu kritischen Aktivitätsverlusten.“

Der tatsächliche Flaschenhals sei nicht die Biologie, sondern die Wirtschaftlichkeit: „Je stärker eine Abfallfraktion kontaminiert ist, desto geringer die Ausbeuten, begleitet mit höherem Aufwand bei Aufarbeitung und Reinigung der Produkte. Das erhöht die Kosten.“

Ein patentierter Moat – mehr als nur ein KI-Hype

Um die Enzyme rasant an neue Herausforderungen anzupassen, nutzt ESTER eine patentierte, KI-gestützte Screening-Technologie. Ist das ein echter Schutzwall gegen gut finanzierte BioTech-Labore in Asien oder den USA? Sonnendecker relativiert den reinen Algorithmus-Hype mit einem treffenden Vergleich: „KI ist heute kein exklusives Werkzeug mehr. Als Schreiben zugänglich wurde, bedeutete das nicht, dass plötzlich jeder ein guter Autor war.“

Der wahre Moat („Burggraben“) liege vielmehr in der eigenen Hardware und der Datenqualität: „Unser patentierter Ansatz basiert auf einer Messmethode, die den Kunststoff mittels Elektrizität selbst beobachtet. Dadurch erhalten wir multiparametrische und hochqualitative Daten. Der eigentliche Moat entsteht deshalb nicht durch ein einzelnes ‚Superenzym‘, sondern durch die integrierte Plattform und den Blick auf das Große.“

Regulatorik als Treiber

Der globale Markt für recyceltes PET (rPET) wird aktuell auf rund 5 Millionen Tonnen beziffert. Angetrieben wird das Wachstum durch strenge EU-Vorgaben (PPWR), die ab 2026 greifen und das Ende des billigen Neu-Plastiks einläuten. Aber was passiert, wenn Plastik aus Erdöl politisch geduldet und weiterhin deutlich billiger bleibt? „Natürlich ist Neu-Plastik aus Erdöl in vielen Fällen günstiger“, räumt Sonnendecker ein. „Aber dieser Preisvorteil basiert auf einer von fossilen Ressourcen abhängigen, linearen Wertschöpfungskette – also einer Sackgasse.“

Deutlicher wird der Gründer beim Blick auf die Konkurrenz. Der französische Marktführer Carbios bindet bereits Giganten wie L'Oréal oder Nestlé an sich. Droht ESTER den Anschluss zu verlieren? „Wir beäugen die Entwicklung von Carbios mit Skepsis“, teilt Sonnendecker selbstbewusst aus.

Tatsächlich geriet der Branchenprimus zuletzt ins Straucheln: Anfang 2025 kündigte Carbios einen drastischen Stellenabbau an, der Bau der ersten industriellen Anlage im französischen Longlaville musste aus Finanzierungsgründen auf 2028 verschoben werden. Stattdessen fokussieren sich die Franzosen nun auf ein Joint Venture mit dem chinesischen PET-Hersteller Wankai, um ab 2026 eine Anlage in Asien hochzuziehen.

Für Sonnendecker ein klares strategisches Warnsignal: „Wir sehen hier die Gefahr, dass europäische Technologie abwandert und genau jene industrielle Resilienz in Europa nicht entsteht, die so wichtig für unsere Unabhängigkeit wäre.“ Der Mitgründer ergänzt: „Weiterhin geht uns Carbios nicht weit genug, denn die Technologie bietet noch viel mehr. Wir konzentrieren uns gezielt auf bislang nicht verwertbare PET-Ströme, die heute in der Verbrennung landen und wollen in Synergie mit mechanischen Recyclern gehen. Und dabei ist PET nur der Anfang: Unser Ziel ist es, aktiv die Kunststoffwelt von morgen mitzugestalten, indem wir unsere Technologien bei der Entwicklung neuer Kunststoffe nach dem Prinzip Design for Circularity ins Spiel bringen. Wir setzen dabei auf die Werkzeuge der Natur, Enzyme, um zukunftsfähige Lösungen skalierbar zu machen und der nächsten Generation von Kunststoffen den Weg in den Markt zu ebnen.“

Die unweigerliche Millionenfrage

ESTER positioniert sich als Angreifer, doch im Jahr 2026 beginnt die kritische Phase. Der Sprung in den industriellen Dauerbetrieb ist in der Biotechnologie historisch extrem kapitalintensiv – das klassische „Valley of Death“. Da die öffentlichen Fördermittel auslaufen, sind nun echte Venture-Capital-Millionen gefragt. Wie will das Start-up überleben, ohne direkt die Mehrheit an Großinvestor*innen abgeben zu müssen?

„Für uns ist entscheidend, nicht in die klassische Falle zu laufen, alles auf eine kapitalintensive eigene Anlage zu setzen“, erklärt der Gründer seine Strategie. Demonstrations- und Pilotanlagen würden lieber angemietet statt selbst gebaut. „Das reduziert den Kapitalbedarf in dieser kritischen Phase erheblich.“ Für die anstehenden Verhandlungen mit großen VC-Fonds zeigt er sich kompromisslos: „Wir kommen nicht aus einer Position des Zwangs, sondern mit validierter Technologie, ersten Umsätzen, starken Partnern und klaren Skalierungspfaden.“

Ist Florian Bretschneider seriös? Kundenberichte, Bewertungen und Hintergrund Einleitung

Wer sich über Online-Business oder neue digitale Tätigkeiten informiert, möchte häufig vorab einschätzen, wie seriös ein Anbieter ist und welche Erfahrungen andere gemacht haben. Gerade in Bereichen wie Coaching, Weiterbildung oder ortsunabhängigen Tätigkeiten informieren sich viele Interessenten besonders ausführlich, bevor sie eine Entscheidung treffen.

Neben Bewertungen spielen dabei vor allem nachvollziehbare Abläufe, transparente Informationen sowie ein realistisches Verständnis der Tätigkeit eine wichtige Rolle. Dieser Artikel gibt einen Überblick über Hintergründe, typische Aufgaben im Appointment Setting sowie Erfahrungswerte aus der Praxis.

Welche Tätigkeit steckt hinter Appointment Setting?

Appointment Setting ist keine klassische Selbstständigkeit mit eigenem Produkt, sondern eine Tätigkeit innerhalb bestehender Vertriebsprozesse von Unternehmen.

Typische Aufgaben sind:

- Bearbeitung eingehender Anfragen über digitale Kanäle anhand klar definierter Abläufe

- Einordnung, ob Anfragen grundsätzlich zum jeweiligen Angebot passen (Vorqualifizierung)

- Koordination und Terminvereinbarung für Beratungsgespräche innerhalb bestehender Systeme

- Unterstützung im Vertriebsprozess durch strukturierte Vorbereitung von Gesprächsterminen

Die Tätigkeit folgt in der Praxis meist strukturierten Prozessschritten, damit Anfragen nachvollziehbar eingeordnet und Termine sinnvoll koordiniert werden können.

Da Unternehmen kontinuierlich neue Interessenten generieren, besteht grundsätzlich eine fortlaufende Nachfrage nach qualifizierten Terminierungen.

Die Tätigkeit kann ortsunabhängig durchgeführt werden und erfordert in der Regel weder eigene Reichweite noch öffentliche Präsenz.

Beispiele für Erfahrungen aus der Praxis

Einige Erfahrungsberichte beziehen sich auf erste praktische Schritte im Bereich digitaler Terminierungsprozesse. Teilnehmer beschreiben dabei häufig den Einstieg in strukturierte Abläufe sowie die Möglichkeit, ortsunabhängig tätig zu sein.

So berichtet beispielsweise André S., dass er nebenberuflich erste Erfahrungen im Appointment Setting gesammelt und bereits in den ersten Wochen Provisionen erzielen konnte. Auch Teilnehmer wie Alice Z. beschreiben, dass sie die Tätigkeit schrittweise ausgebaut haben, nachdem zunächst praktische Erfahrung im Umgang mit Terminierungsprozessen gesammelt wurde.

Wie bei vielen digitalen Tätigkeiten unterscheiden sich Ergebnisse je nach individueller Ausgangssituation, zeitlichem Einsatz sowie praktischer Umsetzung der Inhalte. Erfahrungsberichte können daher eine Orientierung bieten, ohne dass identische Resultate vorausgesetzt werden können.

Einordnung von Erfahrung und Bewertungen

Florian Bretschneider beschäftigt sich seit mehreren Jahren mit digitalen Vertriebsprozessen und Appointment Setting im Coaching- und Beratungsumfeld. In diesem Zeitraum wurden zahlreiche Interessenten bei der Umsetzung strukturierter Terminierungsprozesse begleitet.

Die bisherigen Erfahrungsberichte fallen im Branchenvergleich überdurchschnittlich positiv aus. Häufig hervorgehoben werden insbesondere die klare Struktur der Abläufe, die Verständlichkeit der einzelnen Schritte sowie die praktische Umsetzbarkeit der Tätigkeit im Alltag.

Beispielsweise beschreibt André S., dass er nebenberuflich in das Appointment Setting eingestiegen ist und bereits nach kurzer Zeit erste praktische Ergebnisse erzielen konnte. Auch Teilnehmer wie Alice Z. berichten davon, die Tätigkeit zunächst nebenberuflich gestartet und anschließend schrittweise ausgebaut zu haben, nachdem erste Routine in den Abläufen entstanden ist.

Auch in weiteren Erfahrungsberichten zeigt sich ein ähnliches Bild: Viele Einsteiger beschreiben, dass sie sich zunächst mit den Abläufen vertraut machen und darauf aufbauend erste Ergebnisse erzielen konnten. Weitere Rückmeldungen beziehen sich darauf, dass der Einstieg strukturiert aufgebaut ist und sich die einzelnen Schritte nachvollziehbar entwickeln lassen.

Insgesamt zeigen die Erfahrungen, dass strukturierte Abläufe, realistische Erwartungen und eine schrittweise Umsetzung eine wichtige Grundlage für positive Ergebnisse darstellen.

Transparenz und nachvollziehbare Abläufe

Ein wichtiger Faktor für die Einschätzung der Seriosität ist, ob Inhalte und Abläufe verständlich dargestellt werden. Interessenten möchten vorab nachvollziehen können:

- wie eine Tätigkeit grundsätzlich aufgebaut ist

- welche Aufgaben übernommen werden

- welche Voraussetzungen sinnvoll sein können

- wie die praktische Umsetzung erfolgt

Je klarer Prozesse beschrieben sind, desto leichter lässt sich einschätzen, ob ein Modell zur eigenen Situation passt.

Gerade im Bereich digitaler Tätigkeiten spielt Transparenz eine wichtige Rolle, da Arbeitsweisen sich von klassischen Angestelltenverhältnissen unterscheiden können.

Für wen Appointment Setting geeignet ist – und für wen nicht

Wie bei jeder Tätigkeit ist auch dieses Modell nicht für jede Person gleichermaßen geeignet.

Geeignet kann es sein für:

- Personen mit Interesse an Online-Business

- strukturierte Arbeitsweise

- Interesse an digitalen Geschäftsmodellen

- Wunsch nach ortsunabhängigem Arbeiten

Weniger geeignet kann es sein für:

- Personen, die kein Interesse am Austausch mit Interessenten haben

- Personen, die ausschließlich passives Einkommen erwarten

- Personen ohne Bereitschaft, neue Fähigkeiten zu erlernen

Eine realistische Erwartungshaltung ist entscheidend für eine positive Erfahrung.

Hintergrund und Einordnung der Tätigkeit

Appointment Setting ist ein Bestandteil moderner Vertriebsprozesse, bei denen Unternehmen digitale Kanäle nutzen, um Interessenten strukturiert zu betreuen.

Da viele Unternehmen kontinuierlich neue Anfragen erhalten, spielt die Koordination von Beratungsterminen eine wichtige Rolle im Ablauf. Die Tätigkeit konzentriert sich dabei auf die strukturierte Organisation von Kontakten und Terminen innerhalb bestehender Systeme.

Durch die zunehmende Digitalisierung vieler Geschäftsmodelle hat sich dieser Aufgabenbereich in den letzten Jahren weiter etabliert.

Fazit: Seriosität im Kontext digitaler Tätigkeiten richtig einordnen

Die Einschätzung der Seriosität hängt im Bereich Online-Business häufig davon ab, wie transparent Inhalte dargestellt werden und wie nachvollziehbar Abläufe aufgebaut sind.

Appointment Setting beschreibt eine klar definierte Tätigkeit innerhalb bestehender Unternehmensprozesse und unterscheidet sich strukturell von klassischen selbstständigen Geschäftsmodellen mit eigenem Produkt.

Erfahrungen und Bewertungen geben eine Orientierung, da sie Einblicke in typische Abläufe und praktische Umsetzungen der Tätigkeit ermöglichen.

Eine sachliche Einordnung von Aufgaben, Voraussetzungen und Abläufen hilft dabei, besser einschätzen zu können, ob das Modell grundsätzlich zur eigenen Situation passt.

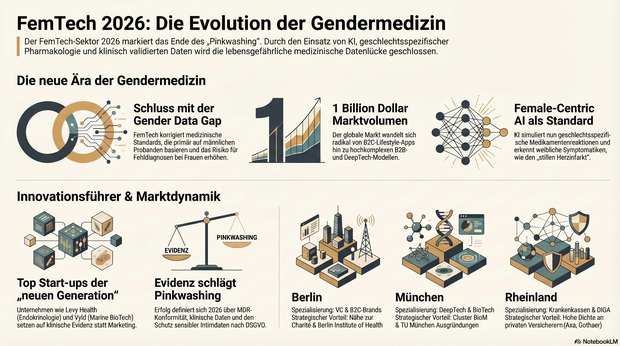

FemTech-Start-up-Report 2026

Schluss mit Pinkwashing! Wie deutsche FemTech-Start-ups 2026 die Gender Data Gap schließen und unser Gesundheitssystem neu codieren.

Lange Zeit belächelt, in eine rosarote Lifestyle-Ecke gedrängt und von männlich dominierten Investment-Komitees als Nischenthema abgetan: FemTech hat einen beispiellosen Reifeprozess hinter sich. Doch der eigentliche Paradigmenwechsel des Jahres 2026 findet tief in der Pharmakologie und der klinischen Forschung statt. Jahrzehntelang galt in der Medizin der 70 Kilogramm schwere Durchschnittsmann als universeller Standard. Die fatale Folge dieser sogenannten Gender Data Gap ist, dass Medikamente primär an männlichen Probanden getestet wurden, weshalb Frauen bis heute ein dramatisch höheres Risiko für Fehldiagnosen und schwere Nebenwirkungen tragen. Der weibliche Körper verstoffwechselt Wirkstoffe aufgrund hormoneller Zyklen und abweichender Enzymaktivitäten völlig anders. Vom einstigen Tabuthema zum DeepTech-Sektor beweist die Branche heute, dass geschlechtsspezifische Medizin kein Nischendasein mehr fristet, sondern ein systemkritisches Versäumnis korrigiert. FemTech schließt endlich diese lebensgefährliche Datenlücke und wird so zum unverzichtbaren Rückgrat einer gerechten, digitalen Medizin.

Datenpower gegen die medizinische Unsichtbarkeit

Der globale Markt für Frauengesundheit steuert laut aktuellen Analysen von McKinsey weltweit auf die Eine-Billion-Dollar-Marke zu. In Deutschland zeigt sich 2026 eine deutliche Konsolidierung. Während die Dealroom-Daten nach dem Hype der frühen 2020er Jahre zunächst eine Delle verzeichneten, hat sich das Investitionsvolumen in der DACH-Region mittlerweile auf einem konstant hohen Niveau stabilisiert. Laut einer Einschätzung der KfW fließen die Gelder heute jedoch smarter: Weg vom überfüllten B2C-Consumer-Markt, hin zu B2B-Modellen und DeepTech.

Der unangefochtene Haupttreiber in diesem Jahr ist die künstliche Intelligenz, die in der Diagnostik, bei der Mustererkennung von Biomarkern und vor allem in der Simulation geschlechtsspezifischer Medikamentenreaktionen neue Standards setzt. Series-A-Runden im zweistelligen Millionenbereich sind für wissenschaftlich validierte Geschäftsmodelle in Deutschland keine Seltenheit mehr, da die Erkenntnis gereift ist, dass eine Medizin, die die Hälfte der Menschheit ignoriert, schlichtweg ökonomisch ineffizient ist.

Gender-Pharmakologie und Female-Centric AI

Die FemTech-Welle der ersten Stunde wurde von Menstruations-Apps dominiert. Pioniere wie das Berliner Start-up Clue haben dafür den Weg bereitet. Doch 2026 dominieren völlig neue, hochkomplexe Sub-Sektoren das Feld. Erstens sehen wir einen massiven Push im Bereich der geschlechtsspezifischen Pharmakologie. Da der weibliche Metabolismus stark von Hormonzyklen beeinflusst wird, nutzen Start-ups heute synthetische Daten und KI, um virtuelle klinische Studien an weiblichen Profilen durchzuführen. Zweitens rückt die geschlechtsspezifische Kardiologie und Onkologie in den Fokus, bei der Algorithmen explizit auf weibliche Symptomatiken – wie den oft unerkannten „stillen Herzinfarkt“ bei Frauen – trainiert werden. Drittens boomt das Metabolische Biomonitoring, das präventiv Autoimmunerkrankungen trackt, die Frauen überproportional oft betreffen. Diese Entwicklung wird massiv durch Einrichtungen wie das Institut für Geschlechterforschung in der Medizin (GiM) an der Berliner Charité flankiert, das die klinische Gendermedizin maßgeblich vorantreibt.

Die Lektionen aus dem Crash der Lifestyle-Apps

Dass der Weg zur Profitabilität steinig ist, zeigte in der jüngeren Vergangenheit das spektakuläre Scheitern des US-Konzerns FemTec Health, der nach einer aggressiven Übernahmewelle – unter anderem des einstigen Schweizer Vorzeige-Start-ups Ava – grandios implodierte. Aus diesem Crash lassen sich für heutige Gründer*innen vier fatale Fallstricke ableiten. Der erste und wichtigste Fehler war die gnadenlose Unterschätzung der europäischen Medizinprodukteverordnung (MDR), die vielen Hardware-Produkten im Nachhinein das Genick brach. Zweitens offenbarten sich völlig zerstörte Unit Economics, da reine Direct-to-Consumer-Modelle durch exorbitante Marketingkosten unprofitabel wurden. Ein dritter Irrtum war das „Pinkwashing“: Es wurde mehr Budget in Lifestyle-Marketing gepumpt als in echte klinische Evidenz, was den Zugang zu essenziellen Krankenkassen-Erstattungen blockierte. Der vierte Fallstrick war die fehlende Spezialisierung auf Gender-Daten; Unternehmen, die lediglich eine weibliche Benutzeroberfläche für männliche Medizinstandards bauten, scheiterten am mangelnden medizinischen Mehrwert.

Wo die geschlechtsspezifische Innovation hierzulande pulsiert

Deutschlands FemTech-Landschaft konzentriert sich 2026 auf hochspezialisierte Hubs. Berlin bleibt der absolute Magnet für Venture Capital und B2C-Brands, stark befeuert durch die Nähe zur Charité und dem Berlin Institute of Health (BIH), das intensiv an der Schließung der Gender Data Gap arbeitet. München hat sich hingegen als das Epizentrum für DeepTech und BioTech etabliert, getragen von den exzellenten Ausgründungen der TU München und dem Cluster BioM. Ein oft unterschätzter, aber extrem relevanter Hotspot ist das Rheinland, insbesondere die Achse Köln/Bonn. Durch die hohe Dichte an privaten Krankenversicherern und Kooperationspartnern wie der Axa oder Gothaer ist dies der ideale Boden für Start-ups, die auf DiGA-Zulassungen schielen. Die Rhein-Neckar-Region um Heidelberg fungiert dank des Deutschen Krebsforschungszentrums (DKFZ) und dem Medizintechnologie-Cluster CUBEX in Mannheim als entscheidende Brücke zwischen harter Onkologie und frauenspezifischer Gesundheitsforschung.

Investor*innen-Radar

Die Investor*innenlandschaft hat sich massiv ausdifferenziert und gleicht 2026 einem hochprofessionellen Ökosystem. Auf der ersten Ebene agieren spezialisierte VCs wie der Auxxo Female Catalyst Fund oder Calm/Storm Ventures, die den Markt mit tiefer Expertise treiben. Die zweite Ebene bilden die Top-Tier Generalisten: Adressen wie Cherry Ventures, HV Capital und der spezialisierte Ableger Earlybird Health haben den ROI von FemTech längst erkannt. Drittens greifen Corporate VCs der Industrie massiv ein; hier positionieren sich Einheiten wie Bayer G4A oder der Roche Venture Fund frühzeitig, um sich strategische Innovationen im Diagnostikbereich zu sichern. Das Fundament bilden hochaktive Business Angels wie Gloria Bäuerlein, Gesa Miczaika und Startup-Verbands-Präsidentin Verena Pausder, die mit ihren Investments echte Signalwirkung erzeugen, während Syndikate wie encourageventures entscheidende Brücken in den Pre-Seed-Phasen bauen.

Die Top Start-ups (Must-Watch)

Für die folgende Auswahl der Top Start-ups des Jahres 2026 haben wir strenge Kriterien angelegt. Im Fokus stehen ausschließlich in Deutschland ansässige Unternehmen der „neuen Generation“ mit einem Gründungsjahr ab 2020. Wir bewerten die Marktrelevanz im Kontext der Gender-Medizin, den technologischen Reifegrad, das Vertrauen namhafter Lead-Investor*innen sowie die Fähigkeit, echte medizinische Datenlücken zu schließen. Die Redaktion hat diese Auswahl unabhängig und ohne finanzielle Gegenleistungen getroffen.

Levy Health (Gründung: 2021)

Das in Berlin gegründete Trio Caroline Mitterdorfer, Priv.-Doz. Dr. med. Theresa Vilsmaier und Silvia Hecher adressiert die komplexe Welt der Endokrinologie. Ihr B2B-SaaS-Produkt ist eine CE-zertifizierte Software zur klinischen Entscheidungsunterstützung, die Mediziner*innen hilft, die wahren Ursachen für weibliche Unfruchtbarkeit schneller zu entschlüsseln. Statt nur hormonelle Daten aufzubereiten, analysiert der Algorithmus umfassende klinische Parameter und Laborwerte, um eine massive diagnostische Lücke in der Reproduktionsmedizin zu schließen. Wie enorm das Skalierungspotenzial dieser Technologie ist, zeigte sich bei einer Seed-Runde über 4,5 Millionen US-Dollar: Angeführt vom US-Fonds XYZ Venture Capital und begleitet von Atlantic Labs, nutzte Levy Health das Kapital, um seinen Hauptsitz strategisch nach San Francisco zu verlegen – während Berlin die entscheidende europäische Entwicklungsbasis bleibt

Ovom Care (Gründung: 2023)

Felicia von Reden, die Gynäkologin Dr. Lynae Brayboy und die renommierte Embryologin Dr. Cristina Hickman heben die Reproduktionsmedizin mit Ovom Care auf ein neues Level. Das als Spin-off des Berliner KI-Studios Merantix gestartete Unternehmen verbindet reale physische Kinderwunschzentren – mit ersten Klinik-Standorten in Lissabon und Großbritannien – mit einer hochkomplexen Software zur Therapieplanung. Der USP: Der Algorithmus nutzt globale Patientinnendaten, um IVF-Behandlungen präzise auf den individuellen weiblichen Körper zuzuschneiden. Für diese technologische Schließung der Datenlücke sammelte das Start-up in einer Seed-Runde 4,8 Millionen Euro ein, angeführt vom Deep-Tech-VC Alpha Intelligence Capital (AIC) unter strategischer Beteiligung von Merantix und Ananda Impact Ventures.

Endo Health (Gründung: 2020)

Die Gynäkologin Dr. med. Nadine Rohloff und der Wirtschaftsinformatiker Markus Rothenhöfer (CIO) haben mit der in Chemnitz ansässigen Endo Health GmbH ein Unternehmen geschaffen, das sich lange Zeit exklusiv der Krankheit Endometriose widmete. Das Ursprungsmodell basiert auf der Endo-App, einer digitalen Gesundheitsanwendung (DiGA), die offiziell vom BfArM gelistet ist und auf Kassenkosten verschrieben werden kann. Im Jahr 2025 vollzog das Start-up jedoch den strategischen Sprung zur Multi-Disease-Plattform und launchte mit „Paula“ eine innovative App-Lösung für Betroffene des Polyzystischen Ovarialsyndroms (PCOS). Dieses enorme technologische Skalierungspotenzial für chronische Frauenkrankheiten überzeugte Geldgeber: Zu den Investoren der jüngsten Expansionsrunden zählen unter anderem Atreyu Investments, Cimexia GmbH, der Berlin Angel Fund und IBB Ventures.

Femfeel (Gründung: 2020)

Das Gründungstrio Janna Kraft, Marie Reger und Michaela Lehr widmet sich mit Femfeel der weiblichen Lebensmitte und überführt die Menopause in die digitale Versorgung. Ihr smartes B2B2C-Modell umgeht langwierige Rezept-Prozesse: Femfeel kombiniert App-basierte Begleitung mit evidenzbasierten Lebensstil-Interventionen, die offiziell als Präventionskurse (nach § 20 SGB V) zertifiziert sind und somit direkt von den Krankenkassen erstattet werden. Wie enorm wertvoll dieser präventive Markt geworden ist, bewies Femfeel durch einen hochbeachteten Exit: Das Start-up wurde von der Medice Health Family – einem Schwergewicht des deutschen Pharma-Mittelstands – übernommen und in dessen Digital-Health-Sparte integriert. Ein historisches Paradebeispiel dafür, wie stark die etablierte Industrie aktuell im FemTech-Sektor konsolidiert.

Frieda (Gründung: 2020)

Valentina Ullrich, Dr. med. Kai Schulze-Wundling und Thanh Schrader-Nguyen adressieren mit Frieda die Gendermedizin in der Menopause und gehen dabei tief in die klinische Diagnostik. Ursprünglich unter dem Namen Loba Health gestartet, agiert das Unternehmen heute als hybride digitale Klinik. Der USP: Statt den Östrogenabfall als Lifestyle-Thema abzutun, kombiniert Frieda datengestützte Telemedizin mit digitaler kognitiver Verhaltenstherapie (CBT) für eine evidenzbasierte Behandlung. Die Menopause wird hier als diagnostisches Fenster begriffen, um Gesundheitsdaten zur aktiven Prävention von altersbedingten Folgekrankheiten (wie Osteoporose) zu nutzen. Dieser konsequente Ansatz überzeugte auch den Schweizer Company Builder Maximon, der diese Brücke zur Langlebigkeit (Longevity) mit einem Seed-Investment von 2,5 Millionen Euro untermauerte.

Vyld (Gründung: 2021)

Ines Schiller und Melanie Schichan transformieren mit Vyld die Monatshygiene durch marine Biotechnologie. Das Start-up bietet sogenannte Kelpons aus Meeresalgen an. Dieser Rohstoff ist nicht nur radikal nachhaltig, sondern liefert einen massiven medizinischen USP: Algen sind von Natur aus hypoallergen, extrem saugfähig und kommen ohne schädliche Bleichmittel oder PFAS (Ewigkeitschemikalien) aus, was das empfindliche vaginale Mikrobiom aktiv schützt. Radikal ist bei Vyld auch die Struktur: Das Start-up agiert im Verantwortungseigentum (Steward-Ownership), wodurch Unternehmenszweck und Sicherheit stets vor kurzfristiger Gewinnmaximierung der Gesellschafter stehen. Dass dieser ethische DeepTech-Ansatz massiv skalieren kann, beweist die Finanzierung: Neben Impact-Investoren wie The Case for Her und millionenschweren Crowdinvesting-Instrumenten wird die Materialforschung von Vyld durch signifikante Fördermittel des Bundesministeriums für Bildung und Forschung (BMBF) validiert.

theblood (Gründung: 2022)

Das Gründerinnen-Duo Isabelle Guenou und Miriam Santer nutzt Menstruationsblut als diagnostische Goldmine. Ihr Geschäftsmodell basiert auf einer innovativen, nicht-invasiven Analyseplattform, die das lange tabuisierte Menstruationsblut nutzt, um ein breites Spektrum an Biomarkern – von Sexualhormonen bis hin zu essenziellen Nährstoffen wie Ferritin (Eisen) – zu tracken. Ein natürliches, zyklisches Abfallprodukt wird so zum hochwertigen Datensatz für die präventive Gesundheitsvorsorge, ganz ohne Nadelstich beim Arzt. Wie resilient und marktreif das Duo agiert, bewies es nach einem medienwirksam geplatzten TV-Investment („Die Höhle der Löwen“): theblood ließ sich nicht beirren und holte stattdessen hochkarätige strategische Partner an Bord. Dass dieser Ansatz massives Vertrauen genießt, zeigt die heutige Riege der Geldgeber: Neben Roosh Ventures und RoX Health investierte unter anderem Klosterfrau Ventures strategisch in die Berliner Pionierarbeit.

Internationaler Ausblick & Fazit

Der Blick über die deutschen Grenzen zeigt 2026 klar, in welche Richtung der Kompass navigiert. Aus den USA schwappt eine massive Welle der KI-basierten Wirkstoffentdeckung speziell für gynäkologische Erkrankungen nach Europa, während Asien die Hardware-Miniaturisierung für kontinuierliches Hormon-Tracking vorantreibt. Ein entscheidender globaler Makro-Trend ist jedoch die Souveränität der Intimdaten. In einer volatilen regulatorischen Ära in den USA (Post-Roe-v.-Wade) hat sich die europäische DSGVO vom Standortnachteil zum ultimativen Wettbewerbsvorteil entwickelt. Internationale Nutzerinnen suchen zunehmend Schutz bei europäischen Plattformen, die strikte Datensicherheit garantieren. Dies eröffnet deutschen Start-ups ungeahnte Exportchancen als absolute Vertrauensführer.

Für Gründer*innen und Investor*innen bedeutet dies: Die Zeit der reinen Wellness-Gadgets ist endgültig vorbei. Wer 2026 erfolgreich sein will, muss die Gender Data Gap schließen, klinische Evidenz liefern und den Datenschutz als ethisches Fundament begreifen. FemTech ist kein Nischen-Portfolio-Baustein mehr für die Diversity-Quote, sondern der am stärksten unterbewertete Treiber für die Zukunft der gesamten Gesundheitsökonomie. Wer heute in Gender-Medizin investiert, investiert in die Qualität der Medizin von morgen.

ODONATAs Sprung zur Multi-Mission-Drohne

Vom scheiternden Lufttaxi-Traum zum taktischen Technologieträger: Das Münchner Start-up ODONATA hat mit dem PANTALA-Hovertest einen entscheidenden Pivot eingeleitet. Am 10. April 2026 erreichte das Unternehmen auf dem Militärflughafen der Bundeswehr im fränkischen Roth einen Meilenstein und absolvierte den ersten Schwebeflug des 1:1-Prototyps seiner Langstreckendrohne. Doch hinter der Erfolgsmeldung steckt eine tiefgreifende strategische Neuausrichtung des 2021 von Dennis Furchheim, Tobias Nickel und Dominik Weigl gegründeten Unternehmens. Wir haben uns mit Co-Founder Dennis Furchheim darüber ausgetauscht.

Gegründet im Jahr 2021 im Rahmen des ESA-Business-Incubation-Programms, verfolgten die ODONATA-Gründer Dennis Furchheim, Tobias Nickel und Dominik Weigl ursprünglich eine weitaus kapitalintensivere Vision: ein bemanntes, wasserstoffbasiertes Flugtaxi (eVTOL). Doch die Realität der Finanzmärkte zwang das Team zum Umdenken. „Die Finanzierung eines solchen Vorhabens ist grundsätzlich schon nicht einfach“, erinnert sich CEO Dennis Furchheim an die kritischen Phasen der letzten fünf Jahre.

Besonders die Probleme anderer Branchengrößen belasteten das junge Unternehmen: „Wenn aber die Entwicklungen, wie beispielsweise bei Lilium, einen in Sippenhaft nehmen, weil nicht unterschieden wird zwischen verschiedenen Konzepten, dann wird es noch härter.“ In dieser Situation habe der „Zeitenwechsel“ und der neue Fokus auf Dual-Use den nötigen Befreiungsschlag ermöglicht.

Mitte 2024 folgte der scharfe Kurswechsel weg vom zertifizierungsrechtlich komplexen Passagiermarkt. Furchheim räumt offen ein, dass dies auch eine Reaktion auf den Standort Deutschland war: „Wir haben ursprünglich mit dem Ziel gestartet, ein eVTOL für Passagiere zu entwickeln und zu produzieren. Wir haben allerdings lernen müssen, dass Investoren in Deutschland nicht in so langfristig angelegte Projekte investieren.“

Der Schwenk zur autonomen Drohne PANTALA sei zwar „hart“ gewesen, doch das Team konnte wertvolle Erfahrungen und Technologien aus der ersten Phase transferieren.

PANTALA: Technik mit Schwerpunkt-Trick

Die nun getestete PANTALA-Drohne ist als Multi-Mission-Plattform konzipiert, die Logistik, Lagebildgewinnung und Drohnenabwehr vereint. Mit einer Spannweite von 7,9 Metern und einem maximalen Startgewicht von 280 Kilogramm kann sie bis zu 80 Kilogramm Nutzlast transportieren. Dank einer hybriden Antriebsarchitektur – batterieelektrisch für Start und Landung, ein Kraftstoffsystem für den Reiseflug – soll sie über zehn Stunden in der Luft bleiben und eine Reichweite von mehr als 1.100 Kilometern erzielen.

Ein technologisches Highlight ist der zum Patent angemeldete verschiebbare Antriebsstrang, der die Schwerpunktsanpassung im Flug bei variierenden Lasten ermöglicht. Angesprochen auf die Zukunftsfähigkeit des Antriebs gibt sich der Gründer pragmatisch. „Wir haben uns bewusst technologieoffen aufgestellt“, betont Furchheim im Hinblick auf die noch fehlende Wasserstoff-Infrastruktur. Er verspricht: „So können wir mit klassischen Treibstoffen, elektrisch und künftig auch mit Wasserstoff fliegen, je nachdem, wie die Infrastruktur sich entwickelt.“

Der Marktdruck und die Konkurrenz

Obwohl ODONATA durch Partner wie die ESA und die TUM Venture Labs Aerospace unterstützt wird, bleibt der Kapitalbedarf massiv. Im Wettbewerb mit bereits etablierten Playern wie Quantum Systems muss sich das Start-up behaupten. Furchheim sieht sein Unternehmen jedoch technologisch im Vorteil.

„Wir haben zwei zentrale Vorteile“, erklärt der CEO selbstbewusst: „Zum einen haben wir eine höhere Payload mit bis zu achtzig Kilogramm, was uns ermöglicht, ganz neue Use-Cases zu bedienen.“ Zudem ermögliche die enorme Reichweite eine Überwachung von Frontabschnitten oder kritischer Infrastruktur über viele Stunden hinweg. Laut Furchheim gibt es bereits konkrete Gespräche mit Interessenten, „die genau auf so etwas warten“.

Zwischen Ethik und Skalierung

Die Ausrichtung auf den Sicherheitssektor bringt neben internationalem Interesse aus den USA, Indien oder der Ukraine auch strikte Rüstungsexportkontrollen mit sich. Auf die Frage nach den regulatorischen Hürden beim Export von Dual-Use-Gütern reagiert der Gründer zurückhaltend, deutet aber eine enge Abstimmung mit nationalen Stellen an. „Ohne zu viel zu verraten, wir sind im Gespräch mit der Bundeswehr, damit wir unser System auf diese Anforderungen hin optimieren“, erklärt Furchheim, räumt jedoch ein: „Aber es ist natürlich eine Hürde, die es nicht leichter macht.“

Der erfolgreiche Hovering-Test markiert den bisher wichtigsten Fortschritt. Der nächste entscheidende Lackmustest für ODONATA wird nun der aerodynamisch anspruchsvolle Übergang in den Reiseflug sein. Nur wenn dieser nahtlos gelingt, wird das System die wachsende internationale Nachfrage tatsächlich bedienen können.

Ende einer Vision: Warum die creätr-Gründerinnen den Stecker ziehen

Es sollte der nachhaltige Gegenentwurf zu Fast Fashion in der Umstandsmode werden. Doch das Frankfurter Label creätr der Gründerinnen Verena Seipp und Viktoria Ibbett zieht nach fünf Jahren den Stecker. Wir haben uns mit den beiden Gründerinnen über das Aus unterhalten: Ein lehrreiches Fallbeispiel über die Tücken hoher Produktionsstandards, falsche Pricing-Strategien und die harte Realität in einem preissensiblen Nischenmarkt.

Der Markt für Umstandsmode ist kein leichter: Die Tragedauer der Kleidung ist naturgemäß begrenzt, weshalb viele werdende Mütter aus Kostengründen zu günstiger Fast Fashion greifen. Genau hier wollten die Frankfurter Schwestern Verena Seipp und Viktoria Ibbett vor fünf Jahren ansetzen. Mit der Gründung ihres Labels creätr traten sie an, um eine hochwertige und funktionale Alternative zu schaffen. Ihre Vision: Kleidung für Schwangerschaft und Stillzeit, die Mütter dank durchdachter Funktionen und modernem Design auch lange nach der Mutterschaft noch begleitet.

Doch die Schere zwischen der Vision einer „erreichbaren Marke“ und der tatsächlichen Marktrealität ging schnell auf. „Das haben wir tatsächlich schon relativ früh gemerkt“, räumt Verena ein. Spätestens in der Produktion sei das Dilemma offensichtlich geworden: „Wenn wir all unsere Ansprüche an faire Herstellung, Nachhaltigkeit und hochwertige, langlebige Materialien erfüllen wollen, landen wir automatisch bei einem Preisniveau, das nicht mehr für alle erreichbar ist.“

Die rote Linie bei der Produktion

Die Fertigung sollte von Beginn an kompromisslos verantwortungsvoll sein und fand daher in Europa – konkret in Deutschland, Portugal und Italien – statt. Dieser ethische und qualitative Anspruch erwies sich rückblickend jedoch als enorme wirtschaftliche Herausforderung.

Hätte man nicht einfach in günstigere, nicht-europäische Länder ausweichen können, um die Preise zu senken? „Am Anfang war das für uns ganz klar eine rote Linie“, betont Viktoria. Man habe ihnen schlichtweg vermittelt, dass faire Arbeitsbedingungen und Qualität nur in Europa wirklich sicherzustellen seien. Heute sieht sie das differenzierter: „Mit zunehmender Erfahrung und einem größeren Netzwerk haben wir gelernt, dass es durchaus auch außerhalb Europas verantwortungsvolle Produktionsmöglichkeiten gibt. Diese Perspektive hatten wir zu Beginn so noch nicht.“

Die Pricing-Falle: Wenn externe Beratung am Markt vorbeigeht

Die hohen europäischen Produktionskosten erzwangen Margen, die das Start-up schnell in eine Sackgasse führten. In der kritischen frühen Aufbauphase verließ sich das Gründerduo auf externe Beratung – und positionierte creätr auf deren Anraten stark im Luxussegment. Ein Blick in das Archiv des Webshops verdeutlicht die harte Dimension: Ein Umstands-Sweatshirt schlug regulär mit 289 Euro zu Buche, ein Hoodie kostete 239 Euro, für ein einfaches Still-T-Shirt wurden 169 Euro aufgerufen.

Warum vertrauten die Schwestern der Beratung mehr als ihrem eigenen Gespür für die Zielgruppe? „Diese Frage trifft den Kern unseres größten Learnings – und wir haben sie uns selbst oft gestellt“, reflektiert Viktoria offen. Als unerfahrene Gründerinnen seien sie davon ausgegangen, dass ein Berater mit jahrzehntelanger Branchenerfahrung den Markt schlicht besser einschätzen könne. Ein fataler Irrtum, wie Verena ergänzt: „Rückblickend war genau das einer unserer größten Fehler.“ Ihr dringender Rat an andere lautet daher: „Vertraue deinem eigenen Bauchgefühl – vor allem, wenn du das Problem und deine Zielgruppe wirklich verstehst.“

Für ein Label, das angetreten war, um eine greifbare Alternative für möglichst viele Mütter zu sein, war dies ein gefährlicher strategischer Schwenk. „In diesem Segment authentisch zu verkaufen, fühlte sich für uns zunehmend nicht richtig an“, resümieren die Gründerinnen heute kritisch. Die tiefe Diskrepanz zwischen dem eigenen moralischen Kompass, dem massiven Preis und der Lebensrealität der Mütter ließ sich auf Dauer nicht überbrücken.

Starke Konkurrenz und psychologische Schwellen

Hinzu kam ein hartes Wettbewerbsumfeld, das verdeutlichte, warum das Luxus-Modell in dieser Nische so schwer durchzusetzen ist. Zwar gibt es einen wachsenden Markt für nachhaltige Maternity Wear, doch selbst etablierte Premium-Wettbewerber wie Boob Design, Mara Mea oder Seraphine rufen für vergleichbare Stücke deutlich niedrigere Preise auf – oft zwischen 60 und 130 Euro.

Auf Babymessen und Pop-up-Events bekamen die Schwestern diese Marktrealität unmittelbar zu spüren. Zwar lobten die Kundinnen die Spürbarkeit der hohen Qualität, doch die Kauflaune blieb aus. „Viele haben offen gesagt, dass sie während der Schwangerschaft ohnehin schon viel fürs Baby ausgeben und deshalb bei sich selbst sparen“, fasst Viktoria die Ernüchterung zusammen. Verena bestätigt das: „Die psychologische Grenze kam immer wieder auf. Viele haben klar gesagt, dass sie – abgesehen vielleicht von einer Winterjacke – nicht bereit sind, über 200 Euro für ein einzelnes Kleidungsstück auszugeben.“ Gegen diese psychologische Hürde bei einer temporären Lebensphase half letztlich auch der Ansatz auf langlebiges Design nicht.

Fazit: Authentizität schlägt Berater-Theorie

Das Ende von creätr ist eine klassische Lektion für die Start-up-Szene. Die mathematisch korrekte Preiskalkulation für eine faire, europäische Produktion muss zwingend mit der Zahlungsbereitschaft des Marktes einhergehen. Wenn externe Strategen ein Unternehmen in ein Segment drängen, das nicht zur Grundidee passt, geht nicht nur die Authentizität verloren, sondern auch das Geschäftsmodell.

Mittlerweile haben die Schwestern die creätr GmbH in Liquidation geschickt und das Ende der Marke angekündigt. Aktuell läuft ein radikaler Schlussverkauf, bei dem sämtliche Teile der Kollektion für nur noch 29 Euro angeboten werden, um die Läger zu leeren und die Kleidung zumindest noch ihrem eigentlichen Zweck zuzuführen. Ein harter Schlussstrich unter ein ambitioniertes Projekt.

Was würden sie anderen Gründerinnen und Gründern in der Sustainable Fashion mit auf den Weg geben? „Sei dir wirklich klar darüber, wofür dein Produkt steht und was du erreichen willst“, rät Verena Seipp eindringlich. „Dieses Ziel sollte dein Nordstern sein – und die Basis für jede Entscheidung.“

Zudem warnt Viktoria Ibbett vor zu großen Ambitionen am Anfang: „Starte klein. Wirklich klein. Konzentriere dich am Anfang auf ein Produkt, teste es, optimiere es und baue darauf auf.“ Dass ihnen damals geraten wurde, direkt mit einer gesamten Kollektion zu starten, sei ein Fehler gewesen. Es war nicht nur teuer, sondern verwässerte auch die Botschaft: „Mit einem klaren Hero-Produkt ist vieles einfacher: Marketing, Kommunikation und vor allem das Verständnis bei den Kundinnen, wofür deine Marke eigentlich steht.“

Angriff auf die Giganten: Das Milliarden-Business mit dem „schnellen Teil“

Wie die SPAREPARTSNOW-Gründer Dr. Christian Hoffart und Sebastian Kleinschmager von München aus den Weltmarkt für Ersatzteile umkrempeln und US-Distributoren das Fürchten lehren wollen.

Ein defektes Bauteil, ein rauchendes Fließband und ein wirtschaftlicher Schaden von 100.000 Euro pro Tag: Der Albtraum eines jeden Werksleiters ist oft bittere Realität. Während der private Konsum längst im „Next-Day-Zeitalter“ angekommen ist, glich die Beschaffung von Industrieteilen bisher einer archäologischen Expedition durch verstaubte Fax-Listen und intransparente Händlerstrukturen. Das Münchner Start-up SPAREPARTSNOW beendet diese Ära nun endgültig und beweist, dass „DeepTech made in Germany“ das Zeug zur globalen Disruption hat.

Die Geburtsstunde einer Milliarden-Idee

Trotz Industrie 4.0 scheiterte der Maschinenbau bisher oft an einer simplen Hürde: der Ersatzteil-Logistik. Zwischen dem Originalhersteller (OEM) und dem Endkunden in den USA oder Asien lagen meist drei bis fünf Zwischenstationen. Jede dieser Stationen kostete wertvolle Zeit und schlug massive Margen auf das Produkt auf. Die Folge war ein absurdes Ungleichgewicht: Ein in Deutschland produziertes Bauteil kam im Ausland oft mit Wochen Verspätung und zum doppelten Preis an.

Hier setzten Dr. Christian Hoffart und Sebastian Kleinschmager im Jahr 2022 an. Ihre Vision war so simpel wie radikal: Die Disintermediation – das radikale Ausschalten des Zwischenhandels. SPAREPARTSNOW verbindet die Industrie-Giganten direkt mit den Fabrikhallen weltweit. Was 2022 mit 20.000 Artikeln begann, ist bis heute – im Februar 2026 – auf ein digitales Ökosystem von über 5 Millionen Ersatzteilen angewachsen.

Der technologische Kraftakt hinter dem Wachstum

Für StartingUp-Leser*innen ist besonders die Skalierung interessant. Von 20.000 auf 5 Millionen Teile zu wachsen, ist kein reiner Vertriebserfolg, sondern eine technologische Meisterleistung. Während Sebastian Kleinschmager im Hintergrund die KI-gestützten Identifikationsalgorithmen verfeinerte, die heute selbst unscharfe Fotos von Bauteilen in Millisekunden zuordnen, musste das Team die Datenhoheit der oft skeptischen OEMs gewinnen.

Strategischer Meilenstein: Frontalangriff auf Nordamerika

Im Februar 2026 steht SPAREPARTSNOW vor seinem bisher kühnsten Schritt: dem Markteintritt in Nordamerika. Die Strategie ist ein Frontalangriff auf etablierte US-Distributoren. Durch die direkte OEM-Anbindung bietet SPAREPARTSNOW europäische Top-Marken in den USA zu Preisen an, die 20 bis 50 Prozent unter dem bisherigen US-Marktniveau liegen. Der „Transatlantik-Express“ garantiert zudem, dass ein Bauteil aus Süddeutschland oft schon am nächsten Werktag in einer US-Fabrik eintrifft. Geschwindigkeit ist hier die einzige Währung, die gegen den drohenden Stillstand hilft.

München oder Silicon Valley?

Trotz der globalen Ambitionen bleibt SPAREPARTSNOW fest in der bayerischen Landeshauptstadt verwurzelt. In einer Welt, in der Start-ups oft schielten, sobald das erste Wagniskapital aus den USA winkte, blieb das Team dem Standort München treu. Hier sitzt die Kompetenz des Maschinenbaus, hier ist die Nähe zu den Herstellern – ein strategischer Vorteil, den kein Algorithmus der Welt ersetzen kann.

Die Zukunft der globalen Instandhaltung

Mit dem Rollout in den USA und dem geplanten Sprung nach Südostasien im dritten Quartal 2026 schließt sich der Kreis zu einem globalen Netzwerk. SPAREPARTSNOW beweist, dass Mut zur Lücke und technologische Tiefe ausreichen, um jahrzehntealte Monopole aufzubrechen. Durch die Kombination aus radikaler Preistransparenz, KI-gestützter Teilesuche und einer Logistik, die Kontinente in Stunden überbrückt, schafft das Unternehmen einen fundamentalen Fortschritt für die weltweite Industrie. In einer Zeit, in der Resilienz und Schnelligkeit über die Wettbewerbsfähigkeit ganzer Wirtschaftsstandorte entscheiden, wird SPAREPARTSNOW vom bloßen Marktplatz zum unverzichtbaren Rückgrat einer digitalisierten, globalen Produktion, die nicht nur schneller und günstiger, sondern durch die Integration von Refurbished-Teilen und reduzierten Lagerwegen auch nachhaltiger agiert.

Über den Wolken, aber digital

Wie das 2020 von Heinz Koop gegründete Aviation Hero den verstaubten Markt der Flugausbildung aufmischt.

Die Ausbildung zum/zur Privatpilot*in galt jahrzehntelang als zeitaufwendig, wenig flexibel und extrem papierlastig. Wer fliegen lernen wollte, musste sich den rigiden Zeitplänen traditioneller Flugschulen unterordnen oder am Wochenende im Aeroclub Arbeitsstunden ableisten. Das Monheimer Start-up Aviation Hero tritt an, um genau diesen Schmerzpunkt zu lösen. Mit dem Claim, „Deutschlands erste volldigitale Flugschule“ zu sein, hat das Unternehmen eine stark regulierte Nische digitalisiert. Wir werfen einen genaueren Blick auf das gebootstrappte Geschäftsmodell, das EdTech mit Luftfahrtrecht verbindet.

Das geht besser!

Hinter Aviation Hero steht der Gründer Heinz Koop. Als er 2018 selbst enthusiastisch seine Ausbildung zum Privatpiloten (PPL) begann, stieß er schnell auf die harte Realität der Branche: trockener Theorieunterricht, unflexible Strukturen und eine hohe Abbruchquote bei den Flugschüler*innen. Aus diesem Negativerlebnis heraus entstand die Geschäftsidee. Im Jahr 2020, mit gerade einmal 22 Jahren, brach Koop sein Studium ab und gründete die Aviation Hero GmbH.

Bemerkenswert in der heutigen Start-up-Landschaft: Das Unternehmen ist zu 100 Prozent gebootstrappt. Anstatt auf Risikokapitalgeber*innen zu setzen, finanzierte Koop das Projekt aus eigenen Mitteln und baute das Angebot organisch auf. Ein massiver Wachstumstreiber war dabei Social Media. Mit einem YouTube-Kanal, der mittlerweile über 14.000 abonnierende Luftfahrt-Enthusiast*innen zählt, schuf sich Koop eine eigene Vertriebs-Pipeline und wurde zum Gesicht der modernen Pilotenausbildung in Deutschland.

„Ein Marathon ohne sichtbare Ziellinie“

Dass der Aufbau eines Unternehmens in einem extrem kapitalintensiven Markt ohne externes Geld kein Spaziergang ist, musste Koop schnell feststellen. „Es gab nicht den einen Tiefpunkt, sondern mehrere Phasen, in denen ich kurz davor war aufzuhören“, erinnert sich der Gründer. Ein besonders kritischer Moment ereignete sich kurz vor dem Launch des ersten Theoriekurses. Die Teilnehmer*innen hatten bereits bezahlt, als der fest eingeplante Fluglehrer plötzlich per Telefon absagte – ausgerechnet, als Koop sich wegen gesundheitlicher Probleme auf einer Ayurveda-Kur in Indien befand.

„Ich stand irgendwo am Strand in Indien, hatte Kunden, die sich auf den Kurs freuten, und keinen Fluglehrer mehr“, beschreibt er die absurde Situation. „Kein Investor, kein Sicherheitsnetz, kein Team das auffängt – alles hing an mir.“ Den Kurs abzusagen, kam für ihn jedoch nicht infrage. Nach unzähligen Telefonaten aus Indien fand er schließlich einen Ersatz, der den Kurs letztlich sogar noch besser betreute. Was ihn in diesen harten Momenten antrieb? „Was mich in solchen Momenten immer zum Weitermachen motiviert hat, waren die Nachrichten von Flugschülern“, betont Koop. Wenn Zweifel aufkamen, las er Nachrichten wie: „Heinz, ohne euch hätte ich meinen Traum nie verwirklicht.“ Seine wichtigste Lektion für andere Gründer*innen lautet daher: „Du brauchst nicht den perfekten Businessplan – du brauchst direktes Kundenfeedback, das dir zeigt, dass das, was du baust, einen echten Unterschied macht. Das ist dein Treibstoff, wenn alles andere wegbricht.“

EdTech im Cockpit

Heute ist Aviation Hero vom Luftfahrt-Bundesamt bzw. der Bezirksregierung als Declared Training Organization offiziell zertifiziert. Das Kerngeschäft ist der Verkauf von digitalen Ausbildungspaketen für angehende Privatpilot*innen, allen voran das Sprechfunkzeugnis („BZF Mastery“) sowie Theorie-Crashkurse für die Lizenzen LAPL und PPL.

Die methodische Umsetzung erinnert dabei an moderne EdTech-Plattformen und kombiniert hochwertig animierte Videolektionen, die Netflix-ähnlich konsumiert werden können, mit interaktiven Live-Q&A-Sessions via Zoom und einer Community-Plattform namens Skool für den direkten Austausch.

Dass die konservativen Luftfahrtbehörden diesen digitalen Ansatz absegneten, war laut Koop weniger ein Kampf als oft vermutet. „Ehrlicherweise war der Ansatz gar nicht so radikal, wie er von außen wirkt“, wiegelt er ab. Zugelassene Fernlehrgänge gab es bereits, doch bestanden diese oft aus endlosen Textwüsten ohne Support. „Wir haben uns gefragt: Wie können wir die Vorteile aus beiden Modellen kombinieren? Herausgekommen ist der Aviation Hero Ansatz“, erklärt Koop.

Die eigentliche Herausforderung sei nicht die Behördenüberzeugung gewesen, sondern die Produktion von Hunderten Videolektionen und der Aufbau der eigenen Methodik. Als das Konzept stand, erkannte die Bezirksregierung in Düsseldorf schnell den Mehrwert. „Die Zusammenarbeit ist seitdem konstruktiv und vertrauensvoll“, versichert der Gründer.

Digitale Disruption gegen E-Learning-Dinosaurier

Der Markt für Flugausbildungen im DACH-Raum ist extrem stark fragmentiert. Neben Hunderten lokalen Flugvereinen gibt es etablierte Branchenriesen wie CAT oder Cranfield Aviation. Doch diese Platzhirsche dominieren primär als B2B-Zulieferer und bieten den Schüler*innen oft textlastiges E-Learning der alten Schule. Aviation Hero fischt hier in einem „Blue Ocean“, indem das Start-up die Endkund*innen (B2C) direkt und professionell über Performance Marketing anspricht.

Wird das Start-up in der traditionellen Branche als feindlicher Disruptor oder als dringend benötigter Modernisierer wahrgenommen? „Beides – und es hängt davon ab, wen du fragst“, räumt Koop ein. Zwar höre er regelmäßig skeptische Stimmen, die auf reinen Präsenzunterricht pochen, doch viele Flugschulen sähen Aviation Hero längst als wertvolle Ergänzung. „Unsere Teilnehmer kommen mit bestandenem BZF und bestandener Theorie zu ihnen – und können vom ersten Tag an das Wetterbriefing lesen, den Funk machen und die Lufträume verstehen“, erklärt er den Vorteil für die Praxis-Schulen. Sein klares Credo: „Wir wollen nicht gegen die Branche arbeiten, sondern mit ihr – aber auf einem modernen Level.“

Wo sind die Turbulenzen?

Trotz über 2.000 begleiteter Schüler*innen gibt es auch Herausforderungen. Die Luftfahrt ist eine der am stärksten reglementierten Branchen der Welt. So verbieten EASA-Richtlinien ein reines Netflix-Modell und fordern einen Anteil an synchronem, betreutem Unterricht von etwa zehn Prozent. Auch Prüfungen müssen physisch bei der Bezirksregierung oder der Bundesnetzagentur abgelegt werden.

Zudem sorgt das Aviation-Hero-Preismodell im Premium-Segment gelegentlich für Diskussionsstoff. Die Kritik: Der reguläre Zugang ist auf vier Monate begrenzt; wer länger braucht, muss monatliche Verlängerungsgebühren zahlen. Auf den Vorwurf eines reinen „Penalty-Pricings“ zur Profitsteigerung reagiert Koop jedoch entschieden: „Die zeitliche Begrenzung ist ein bewusster Teil unseres Ausbildungskonzepts – und zwar im Interesse der Teilnehmer.“