Aktuelle Events

Meta verändert sich für Trump …

… doch was bedeutet der Wandel für die Plattform selbst und was für Influencer und Marken? Ein Kommentar von Philipp Martin, Gründer von Reachbird und Experte für Influencer Marketing im DACH-Raum.

In einer Zeit, in der soziale Medien unseren Alltag mehr denn je prägen, kündigt Meta, das Unternehmen hinter Facebook und Instagram, weitreichende Veränderungen an. Diese Entwicklungen könnten die Plattformen selbst und die Arbeit von Influencern und Marken grundlegend beeinflussen. Als Experte für Influencer Marketing analysiere ich die möglichen Auswirkungen dieser Umwälzungen.

Die Macht der sozialen Medien in Deutschland

Bevor wir uns den spezifischen Änderungen bei Meta zuwenden, lohnt ein Blick auf die derzeitige Bedeutung sozialer Medien in Deutschland. Laut aktuellen Statistiken von Meltwater (2024) nutzen mehr als 80% aller Einwohnerinnen und Einwohner in Deutschland Social Media – und das im Durchschnitt mehr als 1,5 Stunden täglich. Diese Zahlen unterstreichen die enorme Reichweite und den potenziellen Einfluss, den Plattformen wie Facebook und Instagram auf die öffentliche Meinungsbildung haben.

Metas neue Strategie: Abschied vom organisierten Faktencheck

Eine der gravierendsten Änderungen bei Meta betrifft den Umgang mit Faktenchecks. Bisher setzte das Unternehmen auf externe Organisationen, um die Richtigkeit von Informationen zu überprüfen. Nun plant Meta, ähnlich wie bei X (ehemals Twitter), auf die Schwarmintelligenz zu setzen. Meta-Gründer Mark Zuckerberg veröffentlichte ein Video, in welchem er Änderungen im Umgang mit Desinformation und Hate Speech auf seinen Plattformen ankündigte. Diese Entwicklung birgt erhebliche Auswirkungen auf den Wahrheitsgehalt der auf der Plattform geteilten Informationen. Besonders für Influencer und Marken, die auf ihre Glaubwürdigkeit angewiesen sind, entsteht eine neue Herausforderung.

Politische Implikationen

Der Übergang zu einem dezentralisierten System der Inhaltsüberprüfung könnte eine Annäherung an bestimmte politische Strömungen bedeuten. Es stellt sich die Frage, wie die Plattform und ihre Nutzer in Zukunft mit Falschinformationen umgehen werden. Diese Entwicklung könnte als eine Annäherung an die Politik der Republikaner gesehen werden, die durch die Änderungen möglicherweise begünstigt wird. Ein weiterer Aspekt der Änderungen betrifft den Umgang mit sogenannten schädlichen Inhalten. Meta plant, die Regeln in sensiblen Bereichen wie Migration oder Sexualität zu lockern. Diese Lockerung könnte zu einem Anstieg aggressiver, negativer und konfrontativer Beiträge führen. Eine stärkere Polarisierung der Plattform ist zu erwarten – ein Trend, der bereits auf anderen sozialen Netzwerken wie X zu beobachten ist.

Auswirkungen auf das Nutzerverhalten

Die mögliche Zunahme von Hassrede und polarisierenden Inhalten könnte das Nutzererlebnis auf Meta-Plattformen grundlegend verändern. Für Influencer und Marken bedeutet dies, dass sie sich möglicherweise in einem zunehmend negativen Umfeld bewegen müssen. Dies könnte nicht nur ihre Reichweite, sondern auch die Qualität ihrer Interaktionen mit Followern beeinflussen.

Trotz der potenziellen Risiken bietet die Nutzung von Schwarmintelligenz auch Chancen. Es bleibt abzuwarten, wie sich die neue Faktencheck-Strategie langfristig bewährt. Die Möglichkeit, dass jeder mitwirken kann, könnte für mehr Transparenz und schnellere, unkompliziertere Checks sorgen – ähnlich wie bei Wikipedia.

Zukünftig sollen laut Mark Zuckerberg nicht mehr autorisierte Faktenchecker für die Kontrolle sorgen, sondern die Community selbst – indem man mit Community-Notes, ähnlich wie es aktuell bei X bereits der Fall ist, auf falsche Informationen hinweisen kann. Dieser Community-Ansatz ist im ersten Moment nicht schlecht, sondern eine sinnvolle Ergänzung zu dem bestehenden System. Er wird jedoch ohne klare Moderation und ohne professionelle Faktenchecker kaum der Flut an Desinformation auf Social Media gerecht werden können. Vielmehr sollten beide Ansätze genutzt werden, um Desinformation einzudämmen.

Die Verantwortung der Plattformen in Krisenzeiten

Angesichts der bevorstehenden Wahlen und der anhaltenden globalen Krisen tragen Social-Media-Plattformen eine besondere Verantwortung. Gerade in Wahlkampf- und Krisenzeiten müssten sie eigentlich dieser Verantwortung gerecht werden. Diese Verantwortung nehmen sie jetzt nicht mehr wahr. Durch den positiven Effekt, dass über Social Media jede und jeder seine eigene Meinung kundtun und somit an demokratischen Prozessen und der Meinungsbildung uneingeschränkt teilhaben kann, gibt es auch Nachteile. Denn: Wer garantiert, dass es sich bei den veröffentlichten Inhalten um korrekte Informationen handelt? Was, wenn gezielt falsche Informationen über soziale Netzwerke gestreut werden? Gezielte Desinformation über Social Media in Verbindung mit den hohen Nutzerzahlen kann einen großen, negativen Einfluss auf unsere Gesellschaft haben.

Der europäische Kontext: Digital Services Act

Während die angekündigten Änderungen zunächst die USA betreffen, sind sie langfristig auch für den europäischen Markt relevant. Der Digital Services Act in der EU regelt den Umgang mit gezielter Desinformation. Es wird interessant sein zu beobachten, wie Meta diese Regelungen mit seinen neuen Ansätzen in Einklang bringen wird. Umso wichtiger ist es, dass von Seiten der Gesellschaft und auch von Seiten der Plattformen gewisse Regeln aufgesetzt und eingehalten werden. Einen rechtlichen Rahmen bietet in Europa der Digital Services Act, der den Umgang mit gezielter Desinformation regelt.

Auswirkungen auf die Influencer-Welt

Die Änderungen bei Meta haben zudem auch weitreichende Implikationen für die Influencer-Branche. Viele Influencer weltweit gelten als Expertinnen und Experten auf ihren Gebieten - egal ob Fitness- und Gesundheitsinfluencer, Finanzinfluencer oder auch Politikinfluencer. Mit tausenden oder gar Millionen von Abonnenten haben sie einen großen Einfluss und können – wie der Name schon sagt – beeinflussen! Bisher wurde der Content von Influencern nur sehr selten wirklich kontrolliert und eingeschränkt – dies kann durch die neuen Community-Notes auch einen positiven Einfluss auf falsch verbreitete Informationen durch Influencer haben, sofern sich die aktiven Communities der Influencer auch kritisch mit deren Content auseinandersetzen und darauf entsprechend reagieren.

Herausforderung Hate Speech

Ein besonders kritischer Punkt für Influencer ist der Umgang mit Hate Speech. Influencer sind meist täglich Hate Speech ausgesetzt. Eine Einschränkung von Hate Speech war und ist für Influencer von großem Interesse, um in einem positiven Umfeld ihre Inhalte veröffentlichen zu können. Sollte es zu einer Auflösung dieser Einschränkung kommen, so ändert sich die generelle Social Media Tonalität zum Negativen. Einen Vorgeschmack gibt hier ebenfalls die Plattform X, auf welcher es aktuell kaum Einschränkungen gibt und Hate Speech deshalb dort bereits zu einem oft negativ aufgeladenen Community-Klima führt.

Konsequenzen für Marken-Kollaborationen

Die möglichen Veränderungen im Kommunikationsklima auf Meta-Plattformen haben auch Auswirkungen auf die Zusammenarbeit zwischen Marken und Influencern. Die Ziele von Brands in der Zusammenarbeit mit Influencern liegen auf der Hand – es geht um Aufmerksamkeit, Interaktion und Abverkauf. Diese Ziele lassen sich vor allem dann erreichen, wenn das Umfeld positiv ist. Hate Speech bringt mit negativem Kommunikations-Klima auch die Ziele der Markenkommunikation in Gefahr – weshalb wir uns für positive Communities und eine Einschränkung von Hate Speech einsetzen sollten. Gleichzeitig bedeutet dies natürlich nicht, dass kritische Kommentare oder Feedback eingeschränkt werden – es geht rein um das Beschimpfen und Verunglimpfen von Social Media Nutzern.

Blick in die Zukunft: Anpassung und Verantwortung

Es bleibt abzuwarten, wie sich die aktuell angekündigten Änderungen in den USA etablieren werden und zu welchem Resultat dies führt. Für den europäischen Markt wird es vorerst keine Änderungen geben – jedoch sollte die Situation und Entwicklung von Marken, Agenturen und auch Nutzern und Influencern gut beobachtet werden.

Fazit: Eine neue Ära der digitalen Kommunikation

Die von Meta angekündigten Änderungen markieren möglicherweise den Beginn einer neuen Ära in der digitalen Kommunikation. Dieser Wandel bringt nicht nur Herausforderungen, sondern auch Chancen für Influencer und Marken mit sich, insbesondere hinsichtlich der Qualität des Contents und der Authentizität von Informationen.

Die kommenden Monate und Jahre werden zeigen, wie sich diese Veränderungen auf die Social-Media-Landschaft auswirken werden. Eines steht jedoch fest: Influencer, Marken und Nutzer müssen sich auf ein dynamischeres, möglicherweise kontroverseres Umfeld einstellen. Die Fähigkeit, sich anzupassen und verantwortungsvoll zu kommunizieren, wird mehr denn je über den Erfolg in der digitalen Welt entscheiden.

Diese Artikel könnten Sie auch interessieren:

Von Streaming bis Gaming – Diese Branchen profitieren vom digitalen Nutzerverhalten

Wie On-Demand-Modelle Branchen prägen und welche Erfolgsfaktoren Gründer jetzt kennen müssen.

Inhalte, Dienstleistungen und Unterhaltung werden zunehmend flexibel, mobil und individuell konsumiert. Während früher feste Zeiten und physische Angebote dominierten, stehen heute On-Demand-Modelle im Mittelpunkt. Diese Entwicklung wirkt sich nicht nur auf einzelne Produkte aus, sondern prägt ganze Branchen und schafft neue wirtschaftliche Dynamiken. Insbesondere digitale Geschäftsmodelle profitieren von der steigenden Erwartung an Verfügbarkeit, Geschwindigkeit und Personalisierung.

Digitales Nutzerverhalten im Wandel

Die Verschiebung der Nutzungsgewohnheiten von stationären Desktop-Lösungen hin zu mobilen Endgeräten ist der stärkste Treiber der aktuellen Digitalökonomie. On-Demand ist zum Standard geworden: Ob Content, Services oder Unterhaltung – die Erwartungshaltung der Konsumenten ist geprägt von sofortiger Verfügbarkeit und einer hohen Passgenauigkeit durch Personalisierung.

- Inhalte jederzeit abrufbar: Die zeitliche Entkopplung von linearen Sendeplänen oder Öffnungszeiten.

- Omnichannel-Nutzung: Ein nahtloser Übergang zwischen Smartphone, Tablet, Smart-TV und Laptop.

- Komfort als Zahlungsargument: Eine wachsende Bereitschaft, für Zeitersparnis und einfache Bedienbarkeit Abonnements abzuschließen.

Streaming als Vorreiter der digitalen Transformation

Streaming-Dienste gelten als eines der prägendsten Beispiele für die Anpassung an modernes Nutzerverhalten. Klassische Medienformate wurden durch Plattformen ersetzt, die Inhalte jederzeit zugänglich machen. Gleichzeitig haben sich abonnementbasierte Modelle etabliert, die stabile und planbare Einnahmen ermöglichen.

Ein zentraler Erfolgsfaktor liegt in der Nutzung von Daten. Algorithmen analysieren das Verhalten der Nutzer und liefern personalisierte Empfehlungen, wodurch die Verweildauer und Kundenbindung gesteigert werden. Für Unternehmen ergibt sich daraus ein skalierbares Modell, das sich international ausrollen lässt und kontinuierlich optimiert werden kann. Die Grenzkosten pro neuem Nutzer sind minimal. Eine starke Kundenbindung erfolgt hier primär durch exklusiven Content und ein personalisiertes Interface.

In diesem Bereich steht allerdings eine Wende bevor. Durch die große Akzeptanz und Nachfrage sind zahlreiche Angebote und dadurch ein fragmentierter Markt entstanden. Mehrere Abos pro Haushalt sind die Regel und Nutzer wünschen sich zunehmend eine Bündelung.

Gaming und interaktive Unterhaltung auf dem Vormarsch

Gaming hat sich von einer Nische zu einem der weltweit größten digitalen Märkte entwickelt und übertrifft in den Umsätzen längst die Film- und Musikindustrie zusammen. Besonders entscheidend ist hier der soziale Aspekt: Community-Building innerhalb der Spielewelten macht Gaming zu einem sozialen Netzwerk. Der Übergang zu Live-Events und Multiplayer-Erlebnissen schafft eine emotionale Bindung, die weit über das reine Konsumieren hinausgeht.

Gleichzeitig verschiebt sich der Fokus von einmaligen Käufen hin zu kontinuierlichen Einnahmequellen, etwa durch In-Game-Käufe oder abonnementbasierte Modelle. Diese Entwicklung zeigt, wie stark Nutzererlebnisse und soziale Komponenten den Erfolg digitaler Angebote beeinflussen.

iGaming als Teil der digitalen Entertainment-Ökonomie

Innerhalb der digitalen Unterhaltungslandschaft nimmt auch der iGaming-Bereich eine besondere Rolle ein. Dieser Sektor profitiert in ähnlicher Weise von technologischen Entwicklungen wie Streaming und Gaming, insbesondere durch mobile Nutzung, intuitive Benutzeroberflächen und schnelle Transaktionsmöglichkeiten.

Die Plattformen sind darauf ausgelegt, ein möglichst reibungsloses und immersives Nutzererlebnis zu bieten. Online Casino Schweiz präsentiert eine klare Strukturierung unterschiedlicher Games sortiert nach Themen oder Anbietern. Above the fold finden Nutzer Infos zu aktuellen Top-Gewinnern, Verlosungs-Aktionen oder neuen Titeln. Die Kombination aus Gamification-Elementen, internationaler Skalierbarkeit und datenbasierter Optimierung macht diesen Markt aus wirtschaftlicher Perspektive besonders interessant.

Typische Merkmale dieser Branche sind:

- hohe Nutzerbindung durch spielerische Elemente

- globale Ausrichtung digitaler Plattformen

- kontinuierliche Anpassung durch Nutzerdaten

Wirtschaftlichkeit und Transferpotenzial

Die Branche zeichnet sich durch überdurchschnittlich hohe operative Margen aus, da nach der initialen Entwicklung der Plattform und der Integration von Content die Skalierungskosten gering bleiben. Während Marketing- und Lizenzkosten substanziell sind, ermöglichen automatisierte Prozesse in der Kundenverwaltung und Zahlungsabwicklung eine hohe Profitabilität.

Diese Effizienz lässt sich auf andere digitale Angebote übertragen: Das Prinzip der Mikro-Interaktionen und die sofortige Belohnung (Instant Gratification) sind Mechanismen, die auch im E-Commerce oder in Produktivitäts-Apps die Conversion-Rate steigern. Wer lernt, die im iGaming perfektionierten Methoden der Datenanalyse und Echtzeit-Personalisierung zu nutzen, kann die Kundenbindung in nahezu jedem digitalen Geschäftsmodell signifikant erhöhen.

Was Gründer daraus lernen können

Die Analyse erfolgreicher digitaler Branchen zeigt klare Muster. Im Mittelpunkt steht nicht die Technologie selbst, sondern deren Anwendung im Kontext realer Nutzerbedürfnisse. Plattformdenken, Datenanalyse und eine konsequente Ausrichtung auf Benutzerfreundlichkeit sind zentrale Erfolgsfaktoren.

Konkrete Impulse:

- Verhalten statt Produkt: Geschäftsmodelle sollten dort ansetzen, wo Nutzer bereits Zeit verbringen oder Reibungsverluste erleben.

- Iteration: Schnelles Testing von Funktionen (MVP-Ansatz) ermöglicht es, am Puls der Zielgruppe zu bleiben.

- Mobile-First-Denkweise: Jede Lösung muss primär auf dem kleinsten Bildschirm perfekt funktionieren.

- Entwicklung skalierbarer Plattformlösungen

Das digitale Nutzerverhalten entwickelt sich dynamisch weiter und beeinflusst zahlreiche Branchen nachhaltig. Unternehmen, die diese Veränderungen frühzeitig erkennen und in ihre Strategien integrieren, sichern sich entscheidende Wettbewerbsvorteile. Besonders erfolgreich sind Modelle, die Flexibilität, Personalisierung, einfache Zugänglichkeit und die Einbindung in starke App-Ökosysteme miteinander verbinden. In einer zunehmend digitalen Wirtschaft entstehen neue Chancen vor allem dort, wo technologische Möglichkeiten auf veränderte Erwartungen treffen.

Weitere Gewinner des Nutzerwandels

Neben Unterhaltung und Gaming profitieren auch andere Branchen vom veränderten Verhalten. Besonders deutlich wird dies in Bereichen, die auf flexible Nutzung und personalisierte Angebote setzen.

Dazu zählen unter anderem:

- E-Learning-Plattformen, die ortsunabhängiges Lernen ermöglichen

- Fitness- und Gesundheits-Apps, die individuelle Trainingspläne bieten

- Fintech-Lösungen, die schnelle und unkomplizierte Zahlungsprozesse unterstützen

Gemeinsam ist diesen Geschäftsmodellen eine starke Nutzerzentrierung. Sie bieten Lösungen, die sich nahtlos in den Alltag integrieren lassen und dabei individuelle Bedürfnisse berücksichtigen.

Was Gründer daraus lernen können

Der entscheidende Erfolgsfaktor in der digitalen Ökonomie ist die radikale Nutzerzentrierung. Erfolgreiche Unternehmen denken nicht mehr in isolierten Produkten, sondern in Plattformen, die ein Problem ganzheitlich lösen. Die Bedeutung von Datenanalyse zur stetigen Verbesserung der UX kann dabei nicht überschätzt werden.

Die Verfestigung digitaler Gewohnheiten ist ein unumkehrbarer Prozess. Neue Märkte werden dort entstehen, wo technologische Möglichkeiten auf neue menschliche Bedürfnisse treffen. Die größten Chancen liegen für Gründer und etablierte Unternehmen dort, wo sich das Nutzerverhalten schneller wandelt als die bestehenden, oft noch trägen Angebote am Markt.

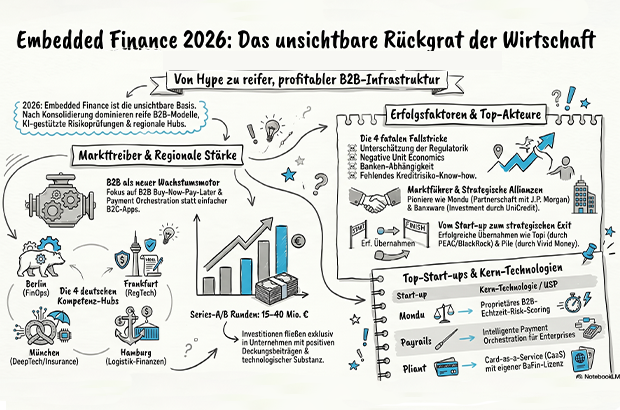

Embedded-Finance-Start-up-Report 2026

Der unsichtbare Bankensektor: Wie Embedded Finance und die dazugehörigen Start-ups die Wirtschaft des Jahres 2026 prägen.

Einst war es das große Versprechen für eine Handvoll hipper Neobanken, heute ist es das unsichtbare Rückgrat der europäischen Wirtschaft: Embedded Finance. Im Jahr 2026 wird das Marktwachstum längst nicht mehr von der fixen Idee isolierter Bank-Apps dominiert, denn jedes zukunftsorientierte Unternehmen ist mittlerweile selbst zu einem/einer Finanzdienstleister*in geworden. Ob Software-as-a-Service-Anbieter*in, Logistik-Plattform oder Marktplatz – die nahtlose Integration von Zahlungen, Krediten und Versicherungen in nicht-finanzielle Kund*innenreisen ist das neue Paradigma.

Dieser Report beleuchtet eine Branche, die den „Sturm der Konsolidierung“ überlebt hat und nun mit reifen Geschäftsmodellen und echten Profiten die Architektur der modernen Wirtschaft neu programmiert.

Vom Hype zur fundamentalen Reife

Nach den massiven Zinsanpassungen und regulatorischen Aufräumarbeiten der Jahre 2023 und 2024 zeichnet der Embedded-Finance-Markt heute ein Bild robuster Reife. Renommierte Analystenhäuser wie Bain & Company und Dealroom haben diese Entwicklung früh vorgezeichnet: Der globale Markt für Embedded-Finance-Dienstleistungen hat sich in ein Multimilliarden-Segment verwandelt, dessen europäisches Transaktionsvolumen mittlerweile signifikante Teile des digitalen B2B- und B2C-Handels stützt. Der technologische Haupttreiber dieser neuen Ära ist unbestreitbar die künstliche Intelligenz, genauer gesagt proprietäre Machine-Learning-Modelle, die Risikobewertungen in Millisekunden durchführen und Transaktionsströme dynamisch optimieren. Investor*innen honorieren diese technologische Tiefe: Wir sehen heute höchst realistische Series-A- und Series-B-Runden im Bereich von 15 bis 40 Millionen Euro für Start-ups, die nachweislich positive Deckungsbeiträge aufweisen. Es fließt wieder signifikant Kapital, doch es fließt exklusiv in Substanz und Skalierbarkeit, nicht mehr in reines Marketing.

Die neuen Treiber: B2B, Vertikalisierung und Orchestrierung

Wenn man über das Offensichtliche wie einfache White-Label-Kreditkarten hinausblickt, dominieren im Jahr 2026 drei spezifische Sub-Sektoren den Markt. Allen voran steht B2B Buy-Now-Pay-Later, eine Disziplin, die das traditionelle, schwerfällige Factoring abgelöst hat und nun direkt in B2B-Checkouts und Beschaffungsnetzwerke integriert ist. Ein weiterer massiver Treiber ist die sogenannte Payment Orchestration für vertikale SaaS-Lösungen. Hier werden komplexe, branchenspezifische Zahlungsflüsse – etwa im Handwerk oder in der Gastronomie – automatisiert im Hintergrund abgewickelt. Zuletzt etabliert sich Embedded Insurance zunehmend im Industriekontext, wo Maschinen nicht mehr nur geleast, sondern im selben Atemzug transaktionsbasiert versichert werden. Pioniere wie die Berliner Mondu oder auch europäische Schwergewichte wie Swan haben den Weg für diese hochspezialisierten Infrastruktur-Layer geebnet und gezeigt, wie tiefgreifend diese Geschäftsmodelle in die Wertschöpfungsketten der Realwirtschaft eingreifen.

Die Lektionen der BaaS-Krise

Doch dieser Reifegrad wurde teuer erkauft. Der Beinahe-Kollaps des britischen Banking-as-a-Service-Pioniers Railsr und die drastischen BaFin-Sonderprüfungen samt Wachstumsbeschränkungen bei etablierten deutschen Playern wie Solaris in den Jahren zuvor haben den Markt fundamental erschüttert. Der Traum, Finanzdienstleistungen wie einfache Legosteine zusammenzustecken, kollidierte brutal mit der harten Realität des Bankwesens.

Aus diesen gescheiterten Hoffnungen lassen sich für heutige Gründer*innen vier konkrete, fatale Fallstricke ableiten. Der erste und wichtigste ist die eklatante Unterschätzung der Regulatorik; Compliance lässt sich nicht auslagern, und Aufsichtsbehörden dulden keine agilen Versuch-und-Irrtum-Prozesse bei der Geldwäscheprävention. Der zweite Fallstrick ist die Falle der negativen Unit Economics im B2C-Sektor, wo exorbitante Kund*innenakquisitionskosten oft nur durch kontinuierliches VC-Geld gedeckt wurden. Drittens das Klumpenrisiko der Abhängigkeit von einer einzigen Partnerbank, deren Ausfall das eigene Start-up über Nacht handlungsunfähig macht. Und viertens die Fehlannahme, dass Technologie allein ausreicht; wer heute kein tiefes Verständnis für klassisches Bilanzstruktur- und Kreditrisikomanagement mitbringt, scheitert unweigerlich.

Das deutsche Netzwerk: Die Schmieden der Infrastruktur

Deutschland hat sich in dieser Konsolidierungsphase als einer der resilientesten Standorte in Europa bewiesen, getragen von vier essenziellen Hubs. Berlin verteidigt dabei seinen Status als unangefochtene Hauptstadt für FinOps und B2B-Zahlungsinfrastruktur, massiv befeuert durch die Talent-Pipelines der TU Berlin sowie das dichte Netzwerk an Serial Entrepreneurs aus der N26- und SumUp-Schule. Frankfurt am Main bildet den unverzichtbaren regulatorischen Gegenpol; hier, im Schatten von EZB und BaFin, entstehen im Umfeld des TechQuartiers und der Frankfurt School of Finance and Management jene Start-ups, die komplexe Compliance- und Treasury-Architekturen für Großbanken bauen. München dominiert den Bereich DeepTech und Embedded Insurance im industriellen B2B-Kontext, was auf die herausragende Stellung des Center for Digital Technology and Management (CDTM) und die enge Verzahnung mit der ansässigen Versicherungs- und Automobilindustrie zurückzuführen ist. Hamburg schließlich hat sich als europäischer Hotspot für Trade Finance und in Logistikketten eingebettete Finanzierungen etabliert, gestützt durch die traditionelle Stärke der Hansestadt im globalen Handel.

Investor*innen-Radar

Das Ökosystem der Geldgeber*innen hat sich im Jahr 2026 stark differenziert und professionalisiert. An der Spitze der spezialisierten VCs agieren Fonds wie FinTech Collective und Motive Ventures (hervorgegangen aus der Übernahme des Berliner VCs embedded/capital), die mit tiefem technologischen Verständnis gezielt in Infrastruktur-Layer investieren. Unter den Top-Tier Generalisten ragen Cherry Ventures, Earlybird und Point Nine heraus, die insbesondere Series-A-Runden bei überzeugenden B2B-SaaS-Modellen anführen.

Ein starker Motor sind zudem Corporate VCs und bankennahe Fonds geworden: CommerzVentures, als unabhängiger Player, treibt Themen wie Climate-Fintech massiv voran, während CVCs der Realwirtschaft wie Allianz X und Porsche Ventures strategisch in Start-ups investieren, die sich nahtlos in ihre eigenen vertikalen Ökosysteme einklinken lassen. In der kritischen Frühphase wird der Markt von einer hochgradig vernetzten Gruppe aus Business Angels angetrieben, die nicht nur erstes Kapital, sondern vor allem regulatorisches Know-how und entscheidende Bankennetzwerke einbringen

Die Top Start-ups (Must-Watch)

Für die nachfolgende Liste der Must-Watch-Unternehmen haben wir strikte Kriterien angelegt. Die Auswahl basiert auf nachgewiesener Marktrelevanz durch echte Kund*innenimplementierungen, einem hohen technologischen Reifegrad und einem diversifizierten Ansatz bei der Lösung komplexer Finanzinfrastrukturprobleme. Zudem war ein nachhaltiges Investoren-Vertrauen in den letzten zwölf Monaten ein Schlüsselfaktor. Wir beleuchten hierbei ausschließlich Start-ups mit Hauptsitz in Deutschland, deren Gründung im Jahr 2020 oder später erfolgte, um die wahre nächste Generation der Branche abzubilden.

Banxware

Das 2020 von Miriam Wohlfarth und Jens Röhrborn gegründete Banxware hat sich als Marktführer für Embedded Lending in Deutschland etabliert. Banxware bietet eine White-Label-Lösung, mit der Marktplätze und Zahlungsdienstleister*innen ihren Händler*innen Sofortkredite basierend auf historischen Umsatzdaten anbieten können. Der USP liegt in der extrem schnellen Risikoprüfung und der nahtlosen API-Integration in bestehende Plattformen. Das enorme Vertrauen der Finanzbranche in dieses Modell spiegelt sich massiv auf Investor*innenseite wider: Neben frühen Leadern wie Element Ventures (heute 13books Capital) ist insbesondere der Einstieg der Großbank UniCredit ein Ritterschlag. Die Bank führte nicht nur die Series-A-Runde an, sondern legte Mitte 2025 mit einem weiteren strategischen Millionen-Investment nach, um die europäische Expansion von Banxware gemeinsam voranzutreiben.

Pliant

Im Jahr 2020 von Malte Rau und Fabian Terner aus der Taufe gehoben, definiert Pliant den Markt für B2B-Kreditkarten und Ausgabenmanagement neu. Das B2B-SaaS-Modell kombiniert eine moderne Karteninfrastruktur mit einer tiefen API-basierten Integration in Buchhaltungs- und ERP-Systeme. Der technologische Vorsprung liegt im eigenen Card-as-a-Service-Angebot (CaaS), das anderen B2B-Plattformen den Launch eigener Kreditkartenprogramme ermöglicht. Ein entscheidender Meilenstein war hierfür der Erhalt der eigenen E-Geld-Lizenz der BaFin, die Pliant die nötige regulatorische Unabhängigkeit verleiht. Unterstützt wird Pliant von namhaften Investoren wie SBI Investment, Alstin Capital – und einem Investment des globalen Schwergewichts PayPal Ventures, das das enorme Skalierungspotenzial der Plattform bestätigt.

Mondu

Die Serial Entrepreneurs Malte Huffmann, Philipp Povel und Gil Danziger gründeten Mondu 2021 und revolutionieren damit den B2B-Zahlungsverkehr. Ihr B2B-BNPL-Modell ermöglicht es Geschäftskund*innen, online wie B2C-Kund*innen auf Rechnung oder in Raten zu kaufen, während der Händler sofort sein Geld erhält. Die Kerntechnologie ist ein proprietäres Echtzeit-Risk-Scoring für Firmenkund*innen. Finanziert wurde diese Vision anfangs von Top-Tier-Fonds wie Valar Ventures und Cherry Ventures. Der ultimative Ritterschlag erfolgte jedoch Ende 2025: Neben dem Erhalt der E-Geld-Lizenz sicherte sich Mondu eine 100-Millionen-Euro-Fazilität von J.P. Morgan Payments inklusive einer strategischen Partnerschaft, um die Buy-Now-Pay-Later-Lösung dem europäischen Kund*innen stamm der US-Großbank anzubieten.

Payrails

Gegründet 2021 von Orkhan Abdullayev, Emre Talay und Nicolas Thouzeau, löst Payrails die Herausforderung der Payment Orchestration. Das FinOps-Start-up baut ein intelligentes Betriebssystem für Zahlungen, das Transaktionen für Enterprise-Kund*innen dynamisch über verschiedene Provider routet, um Kosten zu senken und Autorisierungsraten zu maximieren. Die technologische Brillanz dieser Architektur lockte früh Schwergewichte wie Andreessen Horowitz und EQT Ventures an. Im Sommer 2025 zündete Payrails die nächste Stufe: HV Capital führte eine massive Series-A-Runde über 32 Millionen US-Dollar an, bei der auch alle Top-Tier-Altinvestoren erneut mitzogen, um die globale Expansion der Plattform endgültig zu sichern.

Finmid

Die beiden N26-Alumni Max Schertel und Alexander Talkanitsa starteten Finmid 2021 mit der Mission, jede B2B-Plattform zu einer Finanzierungsquelle zu machen. Ihr Geschäftsmodell fokussiert sich auf Embedded B2B Lending, das speziell auf die Anforderungen von Marktplätzen (wie etwa dem Partner Wolt) zugeschnitten ist – ohne dass diese Plattformen eigenes Kapital bereitstellen oder Risiken tragen müssen. Ihr USP ist die radikale Simplifizierung der B2B-Kreditvergabe durch smarte Echtzeit-Datenverknüpfungen. Angetrieben von einer wuchtigen 23-Millionen-Euro-Series-A-Runde, angeführt vom britischen Fonds Blossom Capital und dem Seed-Lead Earlybird, treibt das Start-up seine aggressive europäische Expansion unaufhaltsam voran.

Topi (Exit)

Charlotte Pallua und Estelle Merle brachten Topi 2021 an den Start, um das Hardware-as-a-Service-Modell in den B2B-Bereich zu integrieren. Über die Plattform können B2B-Kund*innen IT-Equipment flexibel mieten, wobei Topi den gesamten Prozess vom Checkout über das Refinancing bis zum Asset-Management abwickelt. Nachdem Topi mit Händler*innen wie Cyberport massiv skalierte und von Top-VCs wie Index Ventures und Creandum finanziert wurde, erfolgte im Sommer 2025 der strategische Exit: Das FinTech wurde von dem internationalen Leasing-Giganten PEAC Solutions (einem BlackRock-Portfoliounternehmen) übernommen, um das innovative B2B-Mietmodell global in dessen gewaltige Finanzierungsinfrastruktur einzugliedern.

Hakuna

Im Bereich Embedded Insurance schlägt das 2021 von Sebastian Jost, Rupert Mayer und Orhan Köroglu gegründete Hakuna neue Wege ein. Das Start-up bietet Händler*innen eine Plattform für Garantieverlängerungen und Produktschutzversicherungen, nahtlos integriert in den Online- und Offline-Checkout. Der USP ist ein völlig neu gedachtes, digitales Schadensmanagement, das die Abwicklung für Endkund*innen radikal vereinfacht. Finanziert von Top-VCs wie Earlybird und Visionaries Club, hat Hakuna mittlerweile den Sprung ins absolute Enterprise-Segment geschafft: Im Jahr 2025 integrierten Branchenriesen wie Vorwerk, STIHL und Mister Spex die Embedded-Technologie des Start-ups, um ihre eigenen, maßgeschneiderten Produktschutzprogramme europaweit zu skalieren.

Pile (Exit)

Jessica Holzbach startete Pile 2022 und pivotierte das Modell nach dem Krypto-Winter erfolgreich zu einem hochspezialisierten Treasury-Angebot für Start-ups. Die B2B-SaaS-Technologie bündelte Konten und automatisierte die Diversifikation von Einlagen zur Risikominimierung. Das Modell erregte schnell Aufmerksamkeit und führte bereits im Sommer 2024 zu einem frühen Exit: Die 2019 gegründete Berliner Neobank Vivid Money übernahm das Start-up, um das eigene Business-Banking-Angebot mit Piles Treasury-Technologie aufzurüsten – ein Paradebeispiel für die rasante Konsolidierung im FinTech-Infrastrukturmarkt.

Internationaler Ausblick & Fazit

Blickt man über die Grenzen Europas hinaus, formen sich 2026 drei gewaltige Makro-Trends, die den deutschen Markt unausweichlich verändern werden. Aus Asien schwappt die Architektur für grenzüberschreitende Echtzeit-Settlements basierend auf regulierten Stablecoins und digitalen Zentralbankwährungen heran, was das traditionelle Korrespondenzbankensystem massiv unter Druck setzt. Die USA hingegen dominieren die Entwicklung der KI-gesteuerten autonomen Finanzen, bei der das Corporate Treasury von Algorithmen gesteuert wird, die ohne menschliches Zutun Liquidität verschieben. Aus Indien lernen wir, wie Identity-as-a-Service untrennbar mit dem Zahlungsverkehr verschmilzt und Betrug nahezu ausmerzt.

Für Gründer*innen und Investor*innen im DACH-Raum bedeutet dies: Der Fokus muss radikal auf Profitabilität, wasserdichter Compliance und extrem stabiler Infrastruktur liegen. Wer heute in Embedded Finance gewinnt, baut keine bunten Apps mehr, sondern die hochkomplexen, unsichtbaren Stahlträger der digitalen Weltwirtschaft.

KI-Baukasten für den Mittelstand: Kann firepanda.ai das Versprechen der Einfachheit halten?

Das Münchner Start-up firepanda.ai launcht neue Plattform-Features und ein überarbeitetes Preismodell. Mit prominenter Gründer-Erfahrung aus E-Commerce und IT will das Unternehmen den DACH-Mittelstand erobern. Doch wie zukunftssicher ist der Spagat zwischen Orchestrierung und „KI-Steuer“?

Die Integration künstlicher Intelligenz gleicht in vielen mittelständischen Betrieben aktuell noch einem Blindflug. Es fehlen oft Ressourcen für komplexe Implementierungen oder das Know-how zur Einhaltung von Datenschutzstandards. Genau in diese Lücke stößt die Münchner All-in-One-Plattform firepanda.ai. Was im Jahr 2022 als direkte Reaktion auf den globalen „ChatGPT-Moment“ innerhalb eines IT-Entwicklungsbüros begann, will mit einer aktualisierten Plattformversion den Marktzugang für den Mittelstand nun endgültig vereinfachen.

Vom „ChatGPT-Schock“ zum Agentur-Spin-off

Die Geschichte von firepanda.ai nahm ihren Lauf, als die Veröffentlichung von ChatGPT die Tech-Welt erschütterte. In der Münchner IT-Agentur Fireflow erkannten die Gründer sofort den massiven Bedarf – und die gleichzeitige Verunsicherung – bei ihren Kund*innen. Statt den Trend nur zu beobachten, entwickelte das Team in intensiven Konzeptionsphasen eine Lösung, die den deutschen Mittelstand sicher in das KI-Zeitalter führen soll. Anfang 2025 erfolgte dann der offizielle Launch.

Hinter diesem Spin-off stehen zwei Köpfe mit komplementären Profilen. Dr. Peter Dornbusch (CEO & CTO) ist promovierter Informatiker und DeepTech-Veteran mit über 25 Jahren IT-Erfahrung. Flankiert wird er von Daniel Kövary, einem Experten für Business Development und digitale Markenführung.

Auf die Frage, wie schwer der Spagat zwischen anspruchsvollem Agenturgeschäft und der Inkubation einer völlig neuen SaaS-Plattform war, räumt Kövary ein: „Es war zweifellos ein enormer Kraftakt, der sich jedoch als unser größter strategischer Vorteil erwies.“ Durch das Tagesgeschäft sei man extrem nah an den realen Schmerzpunkten der Kund*innen – wie Datenschutzbedenken und Ressourcenmangel – gewesen. Die lange Entwicklungszeit bis 2025 war dabei eine bewusste Entscheidung gegen schnelle halbe Sachen. „Wir wollten keine weitere dünne ‚Wrapper-App‘ auf den Markt bringen“, betont Kövary und fügt hinzu: „Durch KI-gestütztes Coding haben wir eine echte Zeitenwende erlebt und unsere Entwicklungszyklen bei herausragender Code-Qualität massiv verkürzt.“

Schluss mit dem KI-Flickenteppich

Die Kernidee von firepanda.ai ist ein modellagnostisches KI-Backend, das Nutzer*innen flexibel zwischen den Modellen von Anbietern wie OpenAI, Anthropic oder Google wählen lässt, ohne separate Verträge abschließen zu müssen. Ein entscheidender Hebel für den Vertrieb ist dabei die Datensicherheit, da die Plattform auf Servern in Deutschland gehostet wird.

Doch wie garantiert das Start-up rechtssicher, dass Daten bei der Nutzung von OpenAI nicht vom US-Cloud Act erfasst werden? Dr. Peter Dornbusch gibt sich hier kompromisslos: „Um höchste Datenschutzstandards zu gewährleisten, routen wir Anfragen an Modelle wie OpenAI nicht über die Standard-US-Schnittstellen, sondern ausschließlich über DSGVO-konforme Instanzen etablierter Anbieter wie Microsoft Azure oder AWS, die in Europa gehostet werden.“ Dabei würden strikte Zero-Data-Retention-Policies greifen, die verhindern, dass Kund*innendaten für das Modell-Training genutzt werden. Für Unternehmen mit extrem restriktiven Vorgaben bietet firepanda.ai zudem europäische Open-Source-Modelle wie Mistral an, die autark in Deutschland gehostet werden. „Der Kunde ist nicht in einem System gefangen, sondern behält die volle Souveränität“, resümiert der CTO.

KI-Agenten per Drag-and-drop

Um ohne Programmierkenntnisse spezifische KI-Assistenten zu konfigurieren, bietet die Plattform einen Workflow-Builder an, in dem/der Nutzer*in Trigger und Aktionen per Drag-and-drop verknüpfen.

Trotz dieser Versprechen mutieren viele B2B-Start-ups oft zu Beratungsagenturen, weil Kund*innen das Self-Serve-Prinzip nicht allein bewältigen. Daniel Kövary kennt dieses Problem: Die Wucht der Technologie überfordere aktuell noch viele Organisationen. Während globale Player wie Anthropic massiv gegensteuern und sogenannte Forward Deployed Engineers einsetzen, die Use Cases direkt in Unternehmen auf eigene Kosten umsetzen, wählt das Münchner Team einen anderen Pfad. „Da wir diesen extrem ressourcenintensiven Weg weder gehen können noch wollen, lautet unsere strategische Antwort: Enablement!“, stellt Kövary klar. Statt klassischem Handholding setzt man auf ein mehrstufiges Befähigungsmodell im Produkt – von abteilungsspezifischen Prompt-Bibliotheken für Anfänger*innen bis zum Workflow-Builder für Profis. Das Versprechen des Gründers: „Unser primäres Ziel im Onboarding ist es, unternehmensinterne ‚KI-Champions‘ auszubilden, die das Wissen als Multiplikatoren eigenständig skalieren.“

Transparenter Deal oder teure Skalierung?

Seit dem 1. März 2026 lockt firepanda.ai mit einer kostenlosen Testversion inklusive einer Million Token. Im produktiven Einsatz werden 19,95 Euro pro Nutzer*in im Monat fällig, während die Token-Kosten mit einem Handling-Aufschlag von zehn Prozent transparent weitergereicht werden. Zusatzmodule kosten extra: 395 Euro für Workflow-Automatisierung und 95 Euro für API-Anbindungen.

Bislang ist das Start-up komplett bootstrapped. Um die Infrastrukturkosten und die geplante Skalierung zu stemmen, sucht das Unternehmen nun aber sehr selektive Seed-Finanzierungen. Dornbusch sucht dabei explizit nicht nach klassischem Venture Capital, sondern nach „Smart Money“ von strategischen Business Angels. Das ehrgeizige Ziel: „Unser Meilenstein bei diesem kontrollierten Wachstum ist es, durch die anstehende Skalierungsphase bis Ende 2026 den Break-even zu erreichen.“

Die „KI-Steuer“-Falle und wartende Tech-Giganten

Kritiker*innen könnten den zehnprozentigen Token-Aufschlag bei hohen Datenmengen als kostspielige „KI-Steuer“ ansehen, was zur Abwanderung Richtung Direkt-APIs führen könnte. Zudem buhlen globale Wettbewerber wie Make.com oder Microsofts Copilot Studio um den Mittelstand.

Dornbusch wehrt sich gegen den Begriff der Steuer: „Wir sehen diesen zehnprozentigen Aufschlag keineswegs als ‚KI-Steuer‘, sondern als nachvollziehbare Service-Fee.“ Diese Marge decke die komplexe Orchestrierung sowie Compliance-Sicherheit ab und erspare mühsames Vertragsmanagement. Dass Kund*innen bei steigendem KI-Reifegrad abwandern, glaubt er nicht: „Wenn ein Unternehmen erst einmal komplexe Freigabeschleifen, RAG-Pipelines mit proprietären internen Daten und externe API-Trigger in firepanda.ai modelliert hat, wechselt es nicht wegen eines marginal günstigeren Token-Preises die Plattform.“

Und was passiert, wenn Microsoft seinen Copilot so tief integriert, dass externe KMU-Layer überflüssig werden? Kövary kontert, dass Copilot zwar gut für persönliche Produktivität sei, die reale Prozesslandschaft des Mittelstands aber weitaus komplexer. „Wir müssen aufhören, diesen Layer als dünne, überflüssige Benutzeroberfläche zu missverstehen – er ist vielmehr das schützende Betriebssystem eines jeden Unternehmens in der KI-Ära“, argumentiert er. Durch diese Architektur befreie man Kund*innen aus dem Vendor-Lock-in einzelner Großkonzerne.

Genialer Eisbrecher mit Ablaufdatum?

Für die ersten 12 bis 24 Monate der KI-Transformation ist firepanda.ai als technologischer Eisbrecher hochattraktiv. Langfristig muss sich allerdings zeigen, ob die eigenen Workflow-Logiken stark genug sind, um gegen die Marktmacht der großen Ökosysteme zu bestehen.

Gefragt nach der Zukunft und einem möglichen Exit winkt Dr. Peter Dornbusch ab. Die Backend-Entwicklung sei dank 20 Jahren Agenturerfahrung keine Hürde gewesen, sondern der größte strategische Hebel, um eine sichere Enterprise-Umgebung zu schaffen. Man sei gekommen, um zu bleiben: „Ein schneller Exit ist nicht unser Fokus, denn der europäische Markt für B2B-KI steht erst ganz am Anfang“, stellt der CTO klar und gibt die zukünftige Marschroute vor: „Wir bauen hier an einem nachhaltigen und unabhängigen ‚German AI Champion‘, der dem Mittelstand dauerhaft hilft, seine Produktivität messbar und zukunftssicher zu steigern.“

Ist Florian Bretschneider seriös? Kundenberichte, Bewertungen und Hintergrund Einleitung

Wer sich über Online-Business oder neue digitale Tätigkeiten informiert, möchte häufig vorab einschätzen, wie seriös ein Anbieter ist und welche Erfahrungen andere gemacht haben. Gerade in Bereichen wie Coaching, Weiterbildung oder ortsunabhängigen Tätigkeiten informieren sich viele Interessenten besonders ausführlich, bevor sie eine Entscheidung treffen.

Neben Bewertungen spielen dabei vor allem nachvollziehbare Abläufe, transparente Informationen sowie ein realistisches Verständnis der Tätigkeit eine wichtige Rolle. Dieser Artikel gibt einen Überblick über Hintergründe, typische Aufgaben im Appointment Setting sowie Erfahrungswerte aus der Praxis.

Welche Tätigkeit steckt hinter Appointment Setting?

Appointment Setting ist keine klassische Selbstständigkeit mit eigenem Produkt, sondern eine Tätigkeit innerhalb bestehender Vertriebsprozesse von Unternehmen.

Typische Aufgaben sind:

- Bearbeitung eingehender Anfragen über digitale Kanäle anhand klar definierter Abläufe

- Einordnung, ob Anfragen grundsätzlich zum jeweiligen Angebot passen (Vorqualifizierung)

- Koordination und Terminvereinbarung für Beratungsgespräche innerhalb bestehender Systeme

- Unterstützung im Vertriebsprozess durch strukturierte Vorbereitung von Gesprächsterminen

Die Tätigkeit folgt in der Praxis meist strukturierten Prozessschritten, damit Anfragen nachvollziehbar eingeordnet und Termine sinnvoll koordiniert werden können.

Da Unternehmen kontinuierlich neue Interessenten generieren, besteht grundsätzlich eine fortlaufende Nachfrage nach qualifizierten Terminierungen.

Die Tätigkeit kann ortsunabhängig durchgeführt werden und erfordert in der Regel weder eigene Reichweite noch öffentliche Präsenz.

Beispiele für Erfahrungen aus der Praxis

Einige Erfahrungsberichte beziehen sich auf erste praktische Schritte im Bereich digitaler Terminierungsprozesse. Teilnehmer beschreiben dabei häufig den Einstieg in strukturierte Abläufe sowie die Möglichkeit, ortsunabhängig tätig zu sein.

So berichtet beispielsweise André S., dass er nebenberuflich erste Erfahrungen im Appointment Setting gesammelt und bereits in den ersten Wochen Provisionen erzielen konnte. Auch Teilnehmer wie Alice Z. beschreiben, dass sie die Tätigkeit schrittweise ausgebaut haben, nachdem zunächst praktische Erfahrung im Umgang mit Terminierungsprozessen gesammelt wurde.

Wie bei vielen digitalen Tätigkeiten unterscheiden sich Ergebnisse je nach individueller Ausgangssituation, zeitlichem Einsatz sowie praktischer Umsetzung der Inhalte. Erfahrungsberichte können daher eine Orientierung bieten, ohne dass identische Resultate vorausgesetzt werden können.

Einordnung von Erfahrung und Bewertungen

Florian Bretschneider beschäftigt sich seit mehreren Jahren mit digitalen Vertriebsprozessen und Appointment Setting im Coaching- und Beratungsumfeld. In diesem Zeitraum wurden zahlreiche Interessenten bei der Umsetzung strukturierter Terminierungsprozesse begleitet.

Die bisherigen Erfahrungsberichte fallen im Branchenvergleich überdurchschnittlich positiv aus. Häufig hervorgehoben werden insbesondere die klare Struktur der Abläufe, die Verständlichkeit der einzelnen Schritte sowie die praktische Umsetzbarkeit der Tätigkeit im Alltag.

Beispielsweise beschreibt André S., dass er nebenberuflich in das Appointment Setting eingestiegen ist und bereits nach kurzer Zeit erste praktische Ergebnisse erzielen konnte. Auch Teilnehmer wie Alice Z. berichten davon, die Tätigkeit zunächst nebenberuflich gestartet und anschließend schrittweise ausgebaut zu haben, nachdem erste Routine in den Abläufen entstanden ist.

Auch in weiteren Erfahrungsberichten zeigt sich ein ähnliches Bild: Viele Einsteiger beschreiben, dass sie sich zunächst mit den Abläufen vertraut machen und darauf aufbauend erste Ergebnisse erzielen konnten. Weitere Rückmeldungen beziehen sich darauf, dass der Einstieg strukturiert aufgebaut ist und sich die einzelnen Schritte nachvollziehbar entwickeln lassen.

Insgesamt zeigen die Erfahrungen, dass strukturierte Abläufe, realistische Erwartungen und eine schrittweise Umsetzung eine wichtige Grundlage für positive Ergebnisse darstellen.

Transparenz und nachvollziehbare Abläufe

Ein wichtiger Faktor für die Einschätzung der Seriosität ist, ob Inhalte und Abläufe verständlich dargestellt werden. Interessenten möchten vorab nachvollziehen können:

- wie eine Tätigkeit grundsätzlich aufgebaut ist

- welche Aufgaben übernommen werden

- welche Voraussetzungen sinnvoll sein können

- wie die praktische Umsetzung erfolgt

Je klarer Prozesse beschrieben sind, desto leichter lässt sich einschätzen, ob ein Modell zur eigenen Situation passt.

Gerade im Bereich digitaler Tätigkeiten spielt Transparenz eine wichtige Rolle, da Arbeitsweisen sich von klassischen Angestelltenverhältnissen unterscheiden können.

Für wen Appointment Setting geeignet ist – und für wen nicht

Wie bei jeder Tätigkeit ist auch dieses Modell nicht für jede Person gleichermaßen geeignet.

Geeignet kann es sein für:

- Personen mit Interesse an Online-Business

- strukturierte Arbeitsweise

- Interesse an digitalen Geschäftsmodellen

- Wunsch nach ortsunabhängigem Arbeiten

Weniger geeignet kann es sein für:

- Personen, die kein Interesse am Austausch mit Interessenten haben

- Personen, die ausschließlich passives Einkommen erwarten

- Personen ohne Bereitschaft, neue Fähigkeiten zu erlernen

Eine realistische Erwartungshaltung ist entscheidend für eine positive Erfahrung.

Hintergrund und Einordnung der Tätigkeit

Appointment Setting ist ein Bestandteil moderner Vertriebsprozesse, bei denen Unternehmen digitale Kanäle nutzen, um Interessenten strukturiert zu betreuen.

Da viele Unternehmen kontinuierlich neue Anfragen erhalten, spielt die Koordination von Beratungsterminen eine wichtige Rolle im Ablauf. Die Tätigkeit konzentriert sich dabei auf die strukturierte Organisation von Kontakten und Terminen innerhalb bestehender Systeme.

Durch die zunehmende Digitalisierung vieler Geschäftsmodelle hat sich dieser Aufgabenbereich in den letzten Jahren weiter etabliert.

Fazit: Seriosität im Kontext digitaler Tätigkeiten richtig einordnen

Die Einschätzung der Seriosität hängt im Bereich Online-Business häufig davon ab, wie transparent Inhalte dargestellt werden und wie nachvollziehbar Abläufe aufgebaut sind.

Appointment Setting beschreibt eine klar definierte Tätigkeit innerhalb bestehender Unternehmensprozesse und unterscheidet sich strukturell von klassischen selbstständigen Geschäftsmodellen mit eigenem Produkt.

Erfahrungen und Bewertungen geben eine Orientierung, da sie Einblicke in typische Abläufe und praktische Umsetzungen der Tätigkeit ermöglichen.

Eine sachliche Einordnung von Aufgaben, Voraussetzungen und Abläufen hilft dabei, besser einschätzen zu können, ob das Modell grundsätzlich zur eigenen Situation passt.

MANA: Wie Virtual Office Services den Unternehmensalltag neu strukturieren

Ein detailliertes Portrait von MANA: Virtual Office, digitale Prozesse und persönliche Betreuung für Start-ups und KMU.

Die Arbeitswelt hat sich in den vergangenen Jahren grundlegend verändert. Flexible Arbeitsmodelle, digitale Prozesse und ortsunabhängiges Arbeiten sind längst keine Ausnahme mehr, sondern prägen den Alltag vieler Unternehmen. Gleichzeitig stehen insbesondere Start-ups, Selbstständige und kleine Unternehmen vor der Herausforderung, administrative Aufgaben effizient zu organisieren, ohne dabei wertvolle Ressourcen zu verlieren.

Genau an dieser Schnittstelle setzt MANA an. Das Unternehmen positioniert sich als zentraler Ansprechpartner für organisatorische Prozesse im Hintergrund – mit dem Ziel, den Geschäftsalltag einfacher, strukturierter und digitaler zu gestalten. Weitere Informationen zum Leistungsangebot und zur Struktur des Unternehmens finden sich unter https://we-are-mana.com/.

Von der Idee zur Lösung: Warum MANA entstanden ist

Wer gründet, konzentriert sich zunächst auf Produkt, Markt und Wachstum. Doch schnell wird deutlich, dass administrative Aufgaben einen erheblichen Teil der täglichen Arbeit ausmachen. Posteingang, Dokumentenmanagement oder rechtliche Anforderungen gehören zu den grundlegenden Pflichten – sind jedoch selten der eigentliche Fokus eines Unternehmens.

Gerade in kleinen Teams oder bei Einzelunternehmen entstehen dadurch typische Herausforderungen:

- fehlende Zeit für organisatorische Aufgaben

- unklare Abläufe im Umgang mit Dokumenten

- Unsicherheiten bei rechtlichen Anforderungen

- mangelnde Struktur im Tagesgeschäft

MANA setzt genau hier an und verfolgt einen Ansatz, der diese Prozesse bündelt und vereinfacht. Ziel ist es, Unternehmen von administrativen Aufgaben zu entlasten, ohne dass diese eigene Strukturen aufbauen müssen.

Virtual Office neu definiert

Das Konzept des Virtual Office ist grundsätzlich bekannt, wird jedoch häufig auf die Bereitstellung einer Geschäftsadresse reduziert. MANA erweitert diesen Ansatz um digitale und organisatorische Komponenten, die über klassische Angebote hinausgehen.

Im Zentrum stehen dabei:

- eine ladungs- und handelsregisterfähige Geschäftsadresse

- ein strukturierter Postservice

- digitale Bereitstellung eingehender Dokumente

Alle eingehenden Sendungen werden digitalisiert und online zur Verfügung gestellt – in vielen Fällen noch am Tag des Eingangs. Dadurch entsteht ein jederzeit verfügbarer Überblick über wichtige Unterlagen. Originaldokumente können bei Bedarf zuverlässig weitergeleitet werden.

Diese Kombination ermöglicht es Unternehmen, ortsunabhängig zu arbeiten und gleichzeitig alle formalen Anforderungen zu erfüllen.

Persönliche Betreuung als zentraler Unterschied

Ein wesentliches Merkmal von MANA ist der persönliche Ansatz. Während viele Anbieter auf standardisierte Prozesse und automatisierte Abläufe setzen, legt das Unternehmen Wert auf direkte Ansprechpartner und individuelle Betreuung.

Das zeigt sich insbesondere in:

- persönlicher Kommunikation statt anonymem Support

- festen Ansprechpartnern für individuelle Anliegen

- schnellen und nachvollziehbaren Lösungen

Diese Struktur schafft Vertrauen und sorgt dafür, dass Kunden nicht als Nummer behandelt werden. Gerade für kleinere Unternehmen kann dieser persönliche Kontakt ein entscheidender Faktor sein.

Berlin im Fokus – Expansion in weitere Städte

Der aktuelle Schwerpunkt von MANA liegt auf Berlin. Als einer der wichtigsten Gründerstandorte Europas bietet die Stadt ideale Voraussetzungen für junge Unternehmen und innovative Geschäftsmodelle.

Eine Geschäftsadresse in Berlin kann dabei nicht nur formale Vorteile bieten, sondern auch die Außenwirkung eines Unternehmens stärken.

Gleichzeitig ist die Expansion bereits geplant:

- München als nächster zentraler Standort

- perspektivische Erweiterung nach Hamburg und Frankfurt

Diese Entwicklung zeigt, dass das Modell skalierbar ist und sich an unterschiedliche Märkte anpassen lässt.

Digitale Prozesse als Fundament

Ein zentraler Bestandteil des Konzepts ist die konsequente Digitalisierung administrativer Abläufe. Prozesse, die traditionell zeitintensiv und papierbasiert sind, werden hier strukturiert und vereinfacht.

Dazu gehören unter anderem:

- digitale Erfassung und Archivierung von Dokumenten

- ortsunabhängiger Zugriff auf Post und Unterlagen

- klare Strukturierung von Geschäftsprozessen

Der Vorteil liegt in der Transparenz: Unternehmen behalten jederzeit den Überblick über ihre Dokumente und können schnell auf relevante Informationen zugreifen.

Flexible Nutzung von Meetingräumen

Neben den digitalen Services bietet MANA die Möglichkeit, Meetingräume bei Bedarf zu nutzen. Diese können flexibel gebucht werden und eignen sich für unterschiedliche Einsatzbereiche:

- Kundentermine

- Präsentationen

- interne Besprechungen

Dadurch entsteht eine Kombination aus digitaler Flexibilität und physischer Infrastruktur – ohne langfristige Verpflichtungen für feste Büroflächen.

Für wen das Modell besonders geeignet ist

Das Angebot von MANA richtet sich vor allem an Unternehmen, die flexibel arbeiten und gleichzeitig professionelle Strukturen benötigen.

Dazu zählen insbesondere:

- Start-ups in der Aufbauphase

- Selbstständige und Freelancer

- kleine und mittlere Unternehmen

Besonders relevant ist das Modell für Unternehmen, die keine eigenen Büroräume benötigen oder bewusst auf flexible Lösungen setzen. Gleichzeitig profitieren alle, die administrative Prozesse auslagern möchten, ohne die Kontrolle zu verlieren.

Einordnung im Wettbewerbsumfeld

Der Markt für Virtual Offices wächst seit Jahren kontinuierlich und wird zunehmend vielfältiger. Zahlreiche Anbieter positionieren sich mit ähnlichen Grundangeboten, unterscheiden sich jedoch deutlich in ihrer Umsetzung, ihrem Serviceverständnis und ihrer Zielgruppenansprache. Während viele Lösungen stark standardisiert und auf Skalierung ausgelegt sind, zeigt sich bei genauerem Hinsehen, dass nicht alle Anbieter denselben Anspruch an Betreuung und Struktur verfolgen.

MANA wählt hier bewusst einen differenzierten Ansatz. Im Fokus stehen nicht allein digitale Prozesse, sondern deren Kombination mit persönlicher Betreuung und klar nachvollziehbaren Abläufen. Statt anonymer Massenabwicklung setzt das Unternehmen auf direkte Ansprechpartner und eine Zusammenarbeit, die stärker auf individuelle Anforderungen eingeht.

Das zeigt sich insbesondere in:

- dem Fokus auf persönliche Betreuung statt standardisierter Prozesse

- der Verbindung aus digitaler Infrastruktur und individueller Unterstützung

- klar strukturierten, verständlichen Abläufen ohne unnötige Komplexität

Diese Ausrichtung spricht vor allem Unternehmen an, die neben Effizienz auch Wert auf Verlässlichkeit, Transparenz und direkte Kommunikation legen. Gerade für kleinere Unternehmen und Gründer kann dieser Ansatz einen spürbaren Unterschied im Alltag machen.

In einem Interview von MANA mit business-on wird zudem deutlich, wie stark der Fokus auf praxisnahe Lösungen und persönliche Zusammenarbeit gelegt wird – insbesondere mit Blick auf die Bedürfnisse kleiner und wachsender Unternehmen.

Skalierbarkeit und Zukunftsperspektiven

Das Konzept von MANA ist darauf ausgelegt, mit den Anforderungen moderner Unternehmen mitzuwachsen. Gerade in einem Umfeld, das zunehmend von Digitalisierung, Flexibilität und dynamischen Geschäftsmodellen geprägt ist, gewinnen skalierbare Lösungen an Bedeutung. Unternehmen benötigen Strukturen, die sich anpassen lassen – sowohl in frühen Gründungsphasen als auch im weiteren Wachstum.

Digitalisierung, Automatisierung und ortsunabhängige Arbeitsmodelle werden dabei weiterhin eine zentrale Rolle spielen. Lösungen wie die von MANA greifen genau diese Entwicklung auf, indem sie administrative Prozesse vereinfachen und gleichzeitig flexibel erweiterbar bleiben.

Mögliche Entwicklungen umfassen:

- den weiteren Ausbau digitaler Services und automatisierter Abläufe

- die Erweiterung auf zusätzliche Städte und wirtschaftlich relevante Standorte

- die kontinuierliche Optimierung der Nutzererfahrung und Prozessstruktur

Gleichzeitig bleibt der persönliche Ansatz ein wesentlicher Bestandteil des Modells. Auch im Zuge des Wachstums steht die direkte Betreuung im Vordergrund – ein Aspekt, der insbesondere für kleinere Unternehmen und Gründer eine wichtige Rolle spielt. Die Herausforderung wird darin liegen, Skalierung und persönliche Betreuung langfristig in Einklang zu halten.

Fazit

MANA steht exemplarisch für eine Entwicklung, die viele Unternehmen aktuell betrifft: Administrative Prozesse werden zunehmend ausgelagert und digitalisiert, um Ressourcen zu sparen und Abläufe effizienter zu gestalten. Virtual Office Services entwickeln sich dabei von einer ergänzenden Lösung hin zu einem eigenständigen Organisationsmodell, das sich flexibel in unterschiedliche Unternehmensstrukturen integrieren lässt.

Die Kombination aus ladungsfähiger Geschäftsadresse, digitalem Postservice und persönlicher Betreuung bietet eine klar strukturierte Grundlage für den Unternehmensalltag. Besonders für Start-ups, Selbstständige und kleinere Unternehmen entsteht dadurch ein Umfeld, das sowohl Flexibilität als auch Verlässlichkeit ermöglicht – ohne die Notwendigkeit, eigene komplexe Infrastrukturen aufzubauen.

Mit Blick auf die weitere Entwicklung digitaler Arbeitsmodelle ist davon auszugehen, dass die Nachfrage nach solchen Lösungen weiter steigen wird. Unternehmen, die frühzeitig auf strukturierte, digitale und gleichzeitig persönliche Systeme setzen, schaffen sich damit eine stabile Basis für nachhaltiges Wachstum und langfristige Anpassungsfähigkeit.

Zwischen Bildungsdschungel und digitaler Übersicht: Kann das Münchner Start-up kursmap den Weiterbildungsmarkt knacken?

Der Markt für berufliche Weiterbildung in Deutschland ist riesig, extrem fragmentiert – und für Suchende oft frustrierend unübersichtlich. Dariusz Opitek will das Problem mit seinem Start-up kursmap – einer zentralisierten Plattform – lösen. Ein klassisches Plattform-Modell, das schnelles Wachstum verspricht, aber auch bekannte Fallstricke birgt.

Wer in Deutschland nach einer spezifischen beruflichen Fortbildung sucht, landet schnell in einem Labyrinth aus schlecht gepflegten Websites, PDF-Broschüren und intransparenten Preisstrukturen. Genau in diese Lücke stößt die 2025 in München gegründete kursmap GmbH. Erst kürzlich meldete das Start-up einen Meilenstein: Über 150.000 Kurstermine von Präsenz-, Inhouse- und Online-Schulungen sind laut Unternehmensangaben mittlerweile auf der Plattform gebündelt. Doch ist das Modell tragfähig genug, um sich gegen die etablierten Branchengrößen durchzusetzen?

Hinter kursmap steht Gründer und Geschäftsführer Dariusz Opitek. Seine Motivation entsprang einem klassischen Pain Point: Viele Interessierte wissen schlichtweg nicht, welche qualifizierten Anbieter sich in unmittelbarer Nähe befinden. Mit der Vision, „Weiterbildungen sichtbar, digital und einfach zugänglich zu machen“, brachte Opitek die Plattform an den Start.

Doch eine bloße Aggregation von Daten reicht im heutigen Tech-Umfeld selten aus. Bisher steht der Gründer stark im Vordergrund. Auf die Frage, wer neben ihm im Kernteam stehe, um dieses Mammutprojekt zu stemmen, überrascht Opitek mit einer klaren Ansage: „Kursmap ist aktuell noch eine One-Man-Show, und das bewusst.“ Er agiere als Entwickler, SEO-Stratege und Vertriebler in Personalunion. „Was manche als Schwäche sehen, ist für mich ein Vorteil: kurze Entscheidungswege, keine Overhead-Kosten, maximale Fokussierung“, argumentiert der Gründer.

Um sich gegen gut finanzierte Copycats abzusichern, braucht es allerdings einen technologischen Burggraben. Diesen sieht Opitek im Einsatz künstlicher Intelligenz. Er betont, man baue aktuell ein intelligentes Matching-System, das weit über eine klassische Suchmaske hinausgehe. „Nutzer sollen auf Basis ihrer individuellen Situation, ihrer beruflichen Ziele, dem Standort und den aktuellen Marktentwicklungen die passenden Weiterbildungen vorgeschlagen bekommen“, verspricht er. Nicht die erstbeste Option zähle, sondern die richtige. Opitek fasst den Kern seiner Technologie selbstbewusst zusammen: „Das ist keine Datenbank-Logik, das ist ein persönlicher Weiterbildungsberater, der rund um die Uhr verfügbar ist.“

Die Resterampe-Gefahr: Masse statt Klasse?

Die Marke von 150.000 Terminen ist zweifellos beeindruckend. Erreicht wurde dies, indem kursmap die Einstiegshürden für Anbieter bewusst bei null hält, sodass diese eigenständig Profile anlegen können. Genau hier liegt jedoch das größte Risiko: Marktplätze, die auf pure Quantität setzen, laufen schnell Gefahr, mit veralteten Daten oder unseriösen Angeboten der Coaching-Szene überflutet zu werden.

Wie verhindert das Start-up also, zur unregulierten Resterampe zu verkommen? Opitek wehrt sich vehement gegen den Verdacht mangelnder Kontrolle. „Ein niedriger Einstieg bedeutet nicht, dass wir die Augen verschließen, im Gegenteil“, kontert er. Laut dem Geschäftsführer werden alle Profile laufend überprüft, und es gebe klare Prozesse zum Eingreifen. Dass man auf aufwendige Onboarding-Gespräche oder intransparente Anforderungen verzichtet, sei eine sehr bewusste Entscheidung gewesen. Opitek rechtfertigt diesen Weg: „Das schadet besonders kleinen, oft hervorragenden Anbietern, die schlicht nicht die Kapazitäten für bürokratische Hürden haben.“ Sein Credo für die Plattform lautet daher: „Wer gute Kurse anbietet, soll sofort loslegen können. Qualität muss man sich nicht erzwingen, man muss sie fördern.“

Wer zahlt am Ende die Rechnung?

Das Geschäftsmodell basiert auf der kostenlosen Listung für Anbieter*innen, um zügig ein attraktives Angebot aufzubauen. Das Kalkül: Sobald darüber Leads generiert werden, lassen sich diese künftig über Premium-Modelle monetarisieren. Doch um überhaupt Lernende auf die Plattform zu locken, muss kursmap in Google Ads und im organischen Ranking hart gegen etablierte Portale kämpfen – ein Spiel, das meist massiv Kapital verbrennt.

Finanziert das Start-up diesen teuren Sichtbarkeitskampf aus eigener Kraft, oder braucht es dringend externes Venture Capital (VC)? Opitek setzt auf organisches Wachstum durch SEO. „Hochwertige, relevante Inhalte sind die nachhaltigste Investition, die eine Plattform wie kursmap machen kann“, erklärt er. Sichtbarkeit, die man sich hart erarbeite, sei langlebiger als erkaufte Reichweite. Er räumt zwar ein, ergänzend Google Ads zu nutzen, betont jedoch, dass dies hochgradig selektiv passiere. „Kursmap ist und bleibt bootstrapped“, stellt der Gründer klar. Das zwinge das Unternehmen zur Disziplin. Risikokapital sieht er derzeit eher pragmatisch: „Venture Capital ist für uns kein Ziel, sondern eine Option, die wir nur dann in Betracht ziehen würden, wenn sie uns schneller zu unserem Ziel bringt, nicht als Ersatz für ein funktionierendes Modell.“

Der B2B-Pivot: Raus aus dem Google-Hamsterrad

Kursmap agiert in einem Haifischbecken und tritt gegen Portale wie KURSNET, Semigator oder Tech-Riesen wie LinkedIn Learning an. Deutlich spannender als das margenschwache Vermittlungsgeschäft ist daher die langfristige Vision: Opitek plant B2B-Lösungen, mit denen Unternehmen ihre Weiterbildungsbudgets direkt über kursmap verwalten können. Gelingt dieser Wechsel zum B2B-SaaS-Modell, würde sich das Start-up aus der völligen Abhängigkeit vom Google-Traffic befreien.

Doch warum sollten Personalleiter*innen einem Neuling vertrauen statt auf bewährte Features ihrer HR-Software wie Personio oder Workday zu setzen? Auf die konkrete Frage nach der B2B-Strategie bleibt Opitek bei der technischen Ausführung vage und gibt offen zu: „Wie genau wir ihn gestalten, ob als eigenständiges HR-Tool oder als integriertes Feature für Unternehmen, wird die Marktentwicklung zeigen. Wir sind da ehrlich: Wir testen, lernen und passen uns an.“ Gleichzeitig grenzt er sich aber scharf von großen Suiten ab, die oft die inhaltliche Qualität von Weiterbildungsentscheidungen vernachlässigen würden. „Ein Unternehmen, das diesen Mehrwert für seine Mitarbeitenden spürt, wird kursmap nicht als Konkurrenz zu Personio oder Workday sehen, sondern als sinnvolle Ergänzung“, ist Opitek überzeugt.

Booking.com der Bildung oder teure Illusion?

Kursmap greift ein reales Problem in einem oft digital rückständigen Markt auf. Ob das Start-up langfristig aber das „Booking.com für Fortbildungen“ wird, hängt von rigoroser Qualitätssicherung, effizienter Traffic-Skalierung und der Umsetzung der B2B-Pläne ab.

Bleibt am Ende die Frage nach der Langzeitstrategie: Exit oder Industriestandard? Der Gründer strebt die Spitze im deutschsprachigen Raum an, indem man als „aktiver Partner“ fungiere. Gerade weil KI derzeit ganze Berufsbilder umkrempele, bräuchten Menschen laut Opitek keine bloßen Trefferlisten mehr.

„Kursmap soll genau diese Orientierung geben, datenbasiert, individuell, zukunftsgerichtet“, formuliert Opitek seine Ambition. Sollte dies in Deutschland greifen, schließt er eine Expansion nach Europa nicht aus. Einem unkontrollierten Hype erteilt er zum Schluss jedoch eine deutliche Absage: „Wir denken nicht in Szenarien, sondern in Meilensteinen. Erst liefern, dann skalieren.“

Ende einer Vision: Warum die creätr-Gründerinnen den Stecker ziehen

Es sollte der nachhaltige Gegenentwurf zu Fast Fashion in der Umstandsmode werden. Doch das Frankfurter Label creätr der Gründerinnen Verena Seipp und Viktoria Ibbett zieht nach fünf Jahren den Stecker. Wir haben uns mit den beiden Gründerinnen über das Aus unterhalten: Ein lehrreiches Fallbeispiel über die Tücken hoher Produktionsstandards, falsche Pricing-Strategien und die harte Realität in einem preissensiblen Nischenmarkt.

Der Markt für Umstandsmode ist kein leichter: Die Tragedauer der Kleidung ist naturgemäß begrenzt, weshalb viele werdende Mütter aus Kostengründen zu günstiger Fast Fashion greifen. Genau hier wollten die Frankfurter Schwestern Verena Seipp und Viktoria Ibbett vor fünf Jahren ansetzen. Mit der Gründung ihres Labels creätr traten sie an, um eine hochwertige und funktionale Alternative zu schaffen. Ihre Vision: Kleidung für Schwangerschaft und Stillzeit, die Mütter dank durchdachter Funktionen und modernem Design auch lange nach der Mutterschaft noch begleitet.

Doch die Schere zwischen der Vision einer „erreichbaren Marke“ und der tatsächlichen Marktrealität ging schnell auf. „Das haben wir tatsächlich schon relativ früh gemerkt“, räumt Verena ein. Spätestens in der Produktion sei das Dilemma offensichtlich geworden: „Wenn wir all unsere Ansprüche an faire Herstellung, Nachhaltigkeit und hochwertige, langlebige Materialien erfüllen wollen, landen wir automatisch bei einem Preisniveau, das nicht mehr für alle erreichbar ist.“

Die rote Linie bei der Produktion

Die Fertigung sollte von Beginn an kompromisslos verantwortungsvoll sein und fand daher in Europa – konkret in Deutschland, Portugal und Italien – statt. Dieser ethische und qualitative Anspruch erwies sich rückblickend jedoch als enorme wirtschaftliche Herausforderung.

Hätte man nicht einfach in günstigere, nicht-europäische Länder ausweichen können, um die Preise zu senken? „Am Anfang war das für uns ganz klar eine rote Linie“, betont Viktoria. Man habe ihnen schlichtweg vermittelt, dass faire Arbeitsbedingungen und Qualität nur in Europa wirklich sicherzustellen seien. Heute sieht sie das differenzierter: „Mit zunehmender Erfahrung und einem größeren Netzwerk haben wir gelernt, dass es durchaus auch außerhalb Europas verantwortungsvolle Produktionsmöglichkeiten gibt. Diese Perspektive hatten wir zu Beginn so noch nicht.“

Die Pricing-Falle: Wenn externe Beratung am Markt vorbeigeht

Die hohen europäischen Produktionskosten erzwangen Margen, die das Start-up schnell in eine Sackgasse führten. In der kritischen frühen Aufbauphase verließ sich das Gründerduo auf externe Beratung – und positionierte creätr auf deren Anraten stark im Luxussegment. Ein Blick in das Archiv des Webshops verdeutlicht die harte Dimension: Ein Umstands-Sweatshirt schlug regulär mit 289 Euro zu Buche, ein Hoodie kostete 239 Euro, für ein einfaches Still-T-Shirt wurden 169 Euro aufgerufen.

Warum vertrauten die Schwestern der Beratung mehr als ihrem eigenen Gespür für die Zielgruppe? „Diese Frage trifft den Kern unseres größten Learnings – und wir haben sie uns selbst oft gestellt“, reflektiert Viktoria offen. Als unerfahrene Gründerinnen seien sie davon ausgegangen, dass ein Berater mit jahrzehntelanger Branchenerfahrung den Markt schlicht besser einschätzen könne. Ein fataler Irrtum, wie Verena ergänzt: „Rückblickend war genau das einer unserer größten Fehler.“ Ihr dringender Rat an andere lautet daher: „Vertraue deinem eigenen Bauchgefühl – vor allem, wenn du das Problem und deine Zielgruppe wirklich verstehst.“

Für ein Label, das angetreten war, um eine greifbare Alternative für möglichst viele Mütter zu sein, war dies ein gefährlicher strategischer Schwenk. „In diesem Segment authentisch zu verkaufen, fühlte sich für uns zunehmend nicht richtig an“, resümieren die Gründerinnen heute kritisch. Die tiefe Diskrepanz zwischen dem eigenen moralischen Kompass, dem massiven Preis und der Lebensrealität der Mütter ließ sich auf Dauer nicht überbrücken.

Starke Konkurrenz und psychologische Schwellen

Hinzu kam ein hartes Wettbewerbsumfeld, das verdeutlichte, warum das Luxus-Modell in dieser Nische so schwer durchzusetzen ist. Zwar gibt es einen wachsenden Markt für nachhaltige Maternity Wear, doch selbst etablierte Premium-Wettbewerber wie Boob Design, Mara Mea oder Seraphine rufen für vergleichbare Stücke deutlich niedrigere Preise auf – oft zwischen 60 und 130 Euro.

Auf Babymessen und Pop-up-Events bekamen die Schwestern diese Marktrealität unmittelbar zu spüren. Zwar lobten die Kundinnen die Spürbarkeit der hohen Qualität, doch die Kauflaune blieb aus. „Viele haben offen gesagt, dass sie während der Schwangerschaft ohnehin schon viel fürs Baby ausgeben und deshalb bei sich selbst sparen“, fasst Viktoria die Ernüchterung zusammen. Verena bestätigt das: „Die psychologische Grenze kam immer wieder auf. Viele haben klar gesagt, dass sie – abgesehen vielleicht von einer Winterjacke – nicht bereit sind, über 200 Euro für ein einzelnes Kleidungsstück auszugeben.“ Gegen diese psychologische Hürde bei einer temporären Lebensphase half letztlich auch der Ansatz auf langlebiges Design nicht.

Fazit: Authentizität schlägt Berater-Theorie

Das Ende von creätr ist eine klassische Lektion für die Start-up-Szene. Die mathematisch korrekte Preiskalkulation für eine faire, europäische Produktion muss zwingend mit der Zahlungsbereitschaft des Marktes einhergehen. Wenn externe Strategen ein Unternehmen in ein Segment drängen, das nicht zur Grundidee passt, geht nicht nur die Authentizität verloren, sondern auch das Geschäftsmodell.

Mittlerweile haben die Schwestern die creätr GmbH in Liquidation geschickt und das Ende der Marke angekündigt. Aktuell läuft ein radikaler Schlussverkauf, bei dem sämtliche Teile der Kollektion für nur noch 29 Euro angeboten werden, um die Läger zu leeren und die Kleidung zumindest noch ihrem eigentlichen Zweck zuzuführen. Ein harter Schlussstrich unter ein ambitioniertes Projekt.

Was würden sie anderen Gründerinnen und Gründern in der Sustainable Fashion mit auf den Weg geben? „Sei dir wirklich klar darüber, wofür dein Produkt steht und was du erreichen willst“, rät Verena Seipp eindringlich. „Dieses Ziel sollte dein Nordstern sein – und die Basis für jede Entscheidung.“

Zudem warnt Viktoria Ibbett vor zu großen Ambitionen am Anfang: „Starte klein. Wirklich klein. Konzentriere dich am Anfang auf ein Produkt, teste es, optimiere es und baue darauf auf.“ Dass ihnen damals geraten wurde, direkt mit einer gesamten Kollektion zu starten, sei ein Fehler gewesen. Es war nicht nur teuer, sondern verwässerte auch die Botschaft: „Mit einem klaren Hero-Produkt ist vieles einfacher: Marketing, Kommunikation und vor allem das Verständnis bei den Kundinnen, wofür deine Marke eigentlich steht.“

cylibs Kampf um Europas Recycling-Krone

Mit über 140 Millionen Euro an eingeworbenem Kapital im Rücken und einer geplanten Industrieanlage im CHEMPARK Dormagen ist cylib derzeit einer der größten Hoffnungsträger im europäischen Batterierecycling. Nun übernimmt das 2022 von Paul Sabarny, Lilian Schwich und Dr. Gideon Schwich gegründete Aachener Start-up die Führung in einem strategischen Forschungskonsortium für die nächste Batterie-Generation: Natrium-Ionen-Akkus. Doch der Weg von der erfolgreichen Pilotlinie zur rentablen Großindustrie ist steinig – und die Konkurrenz im Kampf um Europas Rohstoffsouveränität formiert sich in Rekordzeit.

Im Jahr 2022 wurde cylib, das ganzheitliche Batterierecyclingunternehmen, in Aachen von Dr. Lilian Schwich (Co-CEO), Paul Sabarny (CTO) und Dr. Gideon Schwich (COO) als Spin-off gegründet. Das Kernteam hat seine technologischen Wurzeln tief in der Forschung an der RWTH Aachen University. Mit enormem Tempo zog das Team erste Pilotanlagen hoch: Bereits knapp neun Monate nach dem Einzug in die Hallen in Aachen Rothe Erde lief die erste Pilotlinie an, die rund 500 Kilogramm Batteriematerial pro Tag verarbeiten kann „Wir haben den Einzug in unsere heutige Recyclingstätte im Januar über den Aufbau der Infrastruktur bis hin zur Inbetriebnahme in weniger als 9 Monaten geschafft. Darauf sind wir im Team sehr stolz“, kommentiert CTO Paul Sabarny den rasanten Aufbau.

Heute, im April 2026, beschäftigt das Unternehmen über 120 Mitarbeitende. Durch Runden mit namhaften Investor*innen wie dem World Fund, 10x Founders, Vsquared Ventures, Porsche Ventures und Bosch Ventures hat das Unternehmen insgesamt über 140 Millionen Euro an Eigenkapital und öffentlichen Fördermitteln akquiriert.

Die Technologie und der Vorstoß bei Natrium-Ionen-Batterien

Das technologische Herzstück von cylib ist die sogenannte OLIC-Technologie (Optimized Lithium and Graphite Recovery). Im Gegensatz zu konventionellen, stark chemie- oder hitzegetriebenen Prozessen setzt cylib auf ein wasserbasiertes Verfahren zur Rückgewinnung. Das Start-up erzielt nach eigenen Angaben eine Recyclingeffizienz von über 90 Prozent für wertvolle Elemente wie Lithium, Graphit, Nickel, Kobalt und Mangan – bei einem um 80 Prozent reduzierten CO2-Fußabdruck im Vergleich zur primären Rohstoffgewinnung. Co-CEO Lilian Schwich betont diesen Ansatz: „Statt auf eine Vielzahl umweltschädlicher und gesundheitsgefährdender Chemikalien setzen wir in der Lithium und Graphit Rückgewinnung überwiegend auf Wasser.“

Aktuell bereitet das Team den Bau seiner ersten Industrieanlage im CHEMPARK Dormagen vor, die für eine jährliche Kapazität von bis zu 60.000 Tonnen (entspricht rund 140.000 Elektrofahrzeugbatterien) ausgelegt ist.

Nun erweitert das Unternehmen seinen Fokus: Cylib leitet fortan gemeinsam mit der Technischen Universität Braunschweig die Recyclingaktivitäten des 25-Partner-Konsortiums „SIB:DE“. Das vom Bundesministerium für Forschung, Technologie und Raumfahrt (BMFTR) mit 14,5 Millionen Euro geförderte Projekt läuft von März 2026 bis Februar 2029. Gemeinsam mit Schwergewichten wie VARTA, EDAG und acht Fraunhofer-Instituten soll Europas erstes industrielles Recyclingverfahren für Natrium-Ionen-Batterien entstehen. Für cylib übernehmen Till Gerlach (Head of R&D) und Lisa Pillar (Projektleiterin SIB:DE) die Verantwortung.

Das erklärte Ziel: Die Kreislaufwirtschaft soll direkt bei der Etablierung der neuen Technologie auf europäischen Märkten mitgedacht und Infrastruktur aufgebaut werden, bevor Altbatterien in großem Maßstab anfallen. Lilian Schwich bringt diese Vorreiterrolle auf den Punkt: „Wir warten nicht darauf, dass sich ausgediente Natrium-Ionen-Batterien ansammeln. Wir integrieren Kreislaufwirtschaft von Anfang an in die Technologie.“

Markt, Skalierung & Wettbewerb

So beeindruckend die technologische Basis und die Kapitalisierung sind, so komplex ist die Realität des Geschäftsmodells. Der Markt für Batterierecycling wird laut Schätzungen des Fraunhofer ISI bis 2040 in Europa auf rund 2,1 Millionen Tonnen anwachsen. Getrieben wird dies durch strenge EU-Regularien, die ab 2027 verbindliche Mindest-Recyclingquoten für kritische Rohstoffe fordern. Der Bedarf für cylibs Dienstleistung ist also zweifellos enorm.

Dennoch muss sich cylib massiven operativen und wirtschaftlichen Herausforderungen stellen:

- Die Hardware-Skalierungsfalle: Der Sprung von einer 500-kg-Tageskapazität auf 60.000 Tonnen pro Jahr im industriellen Maßstab erfordert eine beispiellose operative Exzellenz. Das Geschäft ist extrem kapitalintensiv (CapEx-lastig). Dass Hardware-Skalierung im Recycling tückisch ist, zeigte jüngst der internationale Player Li-Cycle, der bei der Skalierung in Nordamerika mit extremen Kostenüberschreitungen zu kämpfen hatte. Cylib muss beweisen, dass die Anlage in Dormagen nicht nur ökologisch, sondern auch auf Dauer margenstark und im Zeitplan funktioniert.

- Starker Wettbewerb: Cylib agiert keineswegs in einem Vakuum. Etablierte Akteure wie Duesenfeld betreiben in Deutschland bereits seit Jahren Recyclingverfahren auf mechanisch-thermodynamischer Basis. Im direkten Start-up-Ökosystem zieht das Münchner Unternehmen tozero stark an: Das CleanTech-Start-up hat jüngst ebenfalls enorme Skalierungsfortschritte gemacht, seine industrielle Demonstrationsanlage eröffnet und bereits erfolgreich recyceltes Lithium sowie Graphit für kommerzielle Kunden qualifiziert. Auf europäischer Ebene bauen zudem Giganten wie Northvolt (mit „Revolt“) mächtige Inhouse-Recycling-Kapazitäten auf. Der Kampf um die lukrative „Schwarzmasse“ (geschredderte Batterien) wird die Einkaufspreise für Start-ups in die Höhe treiben.

- Das Margen-Problem der Natrium-Technologie: Der Schritt in das Natrium-Ionen-Recycling (SIB) ist ökologisch sinnvoll, aber wirtschaftlich ein Balanceakt. Im Gegensatz zu Lithium-Ionen-Akkus kommen Natrium-Zellen ohne teure kritische Metalle wie Kobalt oder Nickel aus. Für das Recycling bedeutet das: Die extrahierten Materialien erzielen auf dem Rohstoffmarkt deutlich geringere Preise. Die chemische Rückgewinnung (hydrometallurgische Aufbereitung) droht hier unwirtschaftlich zu werden. Es ist daher eine zwingende Notwendigkeit, dass cylib im SIB:DE-Projekt einen dualen Ansatz verfolgt und das sogenannte Direktrecycling erforscht. Dabei werden Aktivmaterialien ohne vollständigen chemischen Aufschluss direkt in die Zellproduktion zurückgeführt. Zwar könnte das die Verarbeitungskosten insbesondere für Produktionsausschuss erheblich senken und die Materialqualität erhalten, jedoch ist die Demonstration im Pilotmaßstab erst für Anfang 2029 geplant. Bis sich dieses Verfahren wirtschaftlich selbst trägt, dürfte noch viel Zeit vergehen.

Fazit

Cylib hat sich durch tiefgreifende wissenschaftliche Expertise, eine aggressive und zugleich clevere Skalierungsstrategie und das Vertrauen großer Geldgeber*innen eine absolute Pole-Position erarbeitet. Mit der Etablierung des SIB:DE-Konsortiums festigt das Unternehmen zudem seinen Anspruch, als Vordenker der Branche zu agieren. Die eigentliche Bewährungsprobe steht Lilian Schwich und ihrem Team jedoch noch bevor: Das fehlerfreie Hochfahren der Industrieanlage in Dormagen in einem Umfeld, in dem die Wettbewerber*innen immer schneller werden. Nur wenn hier der operative Durchbruch gelingt, wird aus dem Versprechen echter Kreislaufwirtschaft ein tragfähiges europäisches Geschäftsmodell.

Über den Wolken, aber digital