Aktuelle Events

Werkzeuge für Frauen

Die Firma Tomboy Tools wurde von den drei Freundinnen Jennifer Imel, Janet Rickstrew und Mary Tatum in Denver (USA) gegründet. Ihr Ziel war es, Werkzeuge speziell für Frauen anzubieten, denn es zeichnete sich ab, dass sich immer mehr Frauen in ihren eigenen vier Wänden handwerklich betätigen.

Laut eine US-amerikanischen Studie sind 38 Prozent der Hausfrauen auch Hobbyhandwerkerinnen. Die zielgruppenspezifischen Werkzeuge von Tomboy Tools zeichnen sich dadurch aus, dass sie in der Regel kleiner und leichter sind als die handelsüblichen.

Zudem sehen sie meist schicker aus. Seit kurzem sind die Produkte auch in Pink erhältlich. Im Vertrieb geht Tomboy Tools ebenfalls neue Wege: Nicht über Baumärkte, sondern im Rahmen von Heimpartys à la Tupperware werden die Werkzeuge von mehr als 1000 Vertriebspartnern, alle Hobbyhandwerkerinnen, in den USA, Kanada und Australien verkauft.

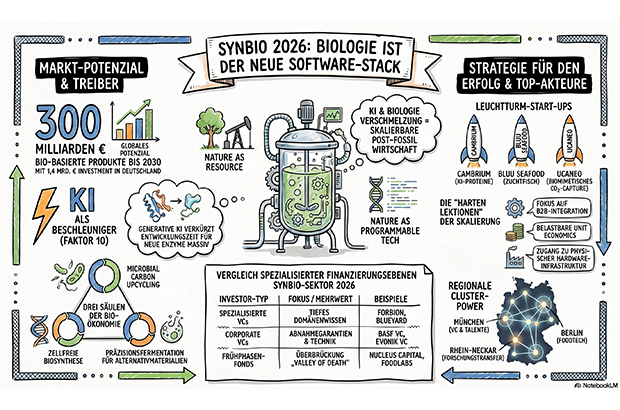

SynBio-Start-up-Report 2026

Biologie ist der neue Code: Wie Synthetische Biologie (SynBio) die Industrie neu programmiert und welche Start-ups dabei hierzulande federführend sind.

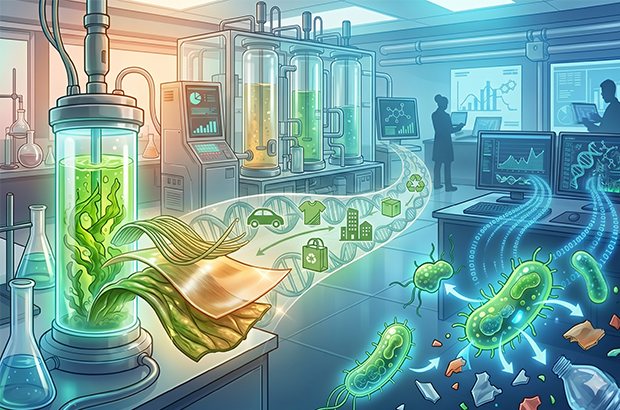

Die Vision einer post-fossilen Wirtschaft ist im Jahr 2026 keine bloße Utopie mehr, sondern eine präzise Ingenieursleistung. Wir erleben den Moment, in dem die Natur von einer Ressource, die wir ausbeuten, zu einer Technologie wird, die wir programmieren. In den Laboren der Republik entstehen heute Lösungen für die größten Versorgungskrisen unserer Zeit. Der Aufstieg der Synthetischen Biologie (SynBio) markiert den Übergang vom Zeitalter der Petrochemie in das Zeitalter der Biomanufaktur – eine Transformation, die so tiefgreifend ist wie die industrielle Revolution, jedoch mit der Geschwindigkeit der digitalen Transformation erfolgt.

Wenn Bits auf Atome treffen

Der SynBio-Markt ist 2026 in eine Phase der industriellen Skalierung eingetreten. Aktuelle Analysen der KfW sowie Branchenberichte von BCG beziffern das globale Marktpotenzial für bio-basierte Produkte bis Ende des Jahrzehnts auf über 300 Milliarden Euro. Allein in Deutschland ist das Investitionsvolumen in DeepTech-BioTech-Start-ups im vergangenen Geschäftsjahr laut Bitkom-Daten auf einen Rekordwert von 1,4 Milliarden Euro gestiegen. Der entscheidende technologische Katalysator ist die Verschmelzung von Generativer KI und Biologie. Dank Modellen, die Proteinfaltungen präziser vorhersagen können, als es je ein menschlicher Forscher vermochte, wurde die Entwicklungszeit für neue Enzyme um den Faktor zehn verkürzt. Die Biologie wird damit endgültig zum „Software-Stack“, bei dem Design-Build-Test-Learn-Zyklen in digitalisierten Bio-Gießereien automatisiert ablaufen.

Jenseits der Petrischale: Die Treiber der Bio-Ökonomie

Drei spezifische Sub-Sektoren dominieren in diesem Jahr die Agenda der Investor*innen. An erster Stelle steht die zellfreie Biosynthese, bei der komplexe Moleküle ohne den Einsatz lebender Zellen produziert werden, was die Skalierbarkeit massiv erhöht. Pioniere wie das US-Unternehmen Solugen haben hier den Weg geebnet, doch deutsche Akteure ziehen in der Effizienz der Bioreaktor-Steuerung nach. Ein zweiter massiver Treiber ist das Microbial Carbon Upcycling: Mikroben werden so programmiert, dass sie industrielles CO2 direkt in hochwertige Proteine oder Kunststoffe umwandeln. Hier verschmelzen Klimaschutz und Produktion zu einer Einheit. Drittens sehen wir den Siegeszug der Biomanufaktur bei Alternativmaterialien – sei es durch Biomasse-Fermentation für Lederersatz aus Myzel oder durch echte Präzisionsfermentation, bei der etablierte Akteure wie die bayrische AMSilk zeigen, dass programmierte Spinnenseide-Proteine bereits in Serie gehen können. Die Lieferkette der Mode- und Automobilindustrie wird durch diese Biopolymere radikal dekarbonisiert.

Die harten Lektionen der Skalierung

Der Weg zum Erfolg war jedoch von schmerzhaften Rückschlägen gepflastert. Der prominente Crash des einstigen Branchenlieblings Amyris im Jahr 2023 wirkt bis heute als warnendes Beispiel nach. Das Unternehmen scheiterte trotz Milliardenbewertung an der Komplexität der vertikalen Integration und dem Versuch, gleichzeitig Technologieplattform und B2C-Marke zu sein. Für heutige Gründer*innen haben sich daraus vier fatale Fallstricke herauskristallisiert, die über Sieg oder Niederlage entscheiden. Erstens: Die Ignoranz gegenüber den Unit Economics. Ein Produkt, das im 5-Liter-Maßstab funktioniert, muss im 50.000-Liter-Kessel nicht zwangsläufig profitabel sein. Zweitens: Das „Regulatorik-Vakuum“. Wer die EU-Novel-Food-Verordnungen oder GVO-Richtlinien nicht von Tag eins an in die Produktentwicklung einplant, riskiert Jahre des Stillstands. Drittens: Die Fokussierung auf den Endkonsument*innen statt auf B2B-Integration. Der wahre Hebel liegt in der Lizenzierung von Prozessen an die Industrie. Viertens: Die Unterschätzung der Hardware-Komponente. SynBio ist kein reines Software-Business; ohne Zugang zu physischer Infrastruktur bleibt jede Innovation im Labor gefangen.

Deutschlands Bio-Cluster

Deutschland hat sich im internationalen Vergleich als einer der stärksten Hubs für SynBio etabliert, getrieben durch eine einzigartige Verzahnung von Spitzenforschung und industrieller Basis. In München und dem angeschlossenen IZB Martinsried konzentriert sich die größte Dichte an Venture Capital und Talenten, eng flankiert durch die Exzellenz-Cluster der TU München. Berlin hat sich durch spezialisierte Inkubatoren wie den ProVeg Incubator, Atlantic Food Labs (FoodLabs) und den Science Park Berlin-Buch zum absoluten Zentrum für FoodTech und zelluläre Landwirtschaft entwickelt. Ein weiterer Hotspot ist das Rhein-Neckar-Delta rund um Heidelberg, wo das European Molecular Biology Laboratory (EMBL) und der BioRN-Cluster eine Brücke zwischen Grundlagenforschung und Marktreife schlagen. Aachen punktet mit der RWTH und einer starken Fokussierung auf Bio-Verfahrenstechnik, während der Raum Darmstadt/Frankfurt durch die Nähe zu Giganten wie Merck und die TU Darmstadt als Kraftzentrum für die industrielle Bioproduktion gilt.

Investor*innen-Radar

Die Finanzierungslandschaft hat sich spezialisiert. Wir unterscheiden im Jahr 2026 vier Ebenen der Kapitalgeber*innen. Die spezialisierten VCs wie Forbion, BlueYard Capital oder Sofinnova Partners bringen das notwendige tiefe Domänenwissen mit. Auf der zweiten Ebene stehen Top-Tier Generalisten wie HV Capital und Earlybird, die SynBio zunehmend als Teil ihrer Dekarbonisierungs-Strategie begreifen. Besonders kritisch für die Skalierung sind die Corporate VCs der Industrie, allen voran BASF Venture Capital und Evonik Venture Capital, die nicht nur Geld, sondern auch Abnahmegarantien und technisches Know-how bieten. In der Frühphase bewegen zudem spezialisierte Mikro-Fonds wie Nucleus Capital oder erfahrene ClimateTech-Angels den Markt, oft organisiert in Syndikaten, die das „Valley of Death“ zwischen Labor und Prototyp überbrücken

Die Top-Start-ups: Unsere Must-Watch-Liste 2026

Für die folgende Auswahl der Start-ups haben wir Unternehmen analysiert, die nach 2019 in Deutschland gegründet wurden. Die Auswahlkriterien basieren auf der technologischen Tiefe (IP-Portfolio), dem Reifegrad der Pilotierung, der Validierung durch renommierte Investoren sowie dem Potenzial, bestehende industrielle Lieferketten systemisch zu verändern. Diversität in Gründungsteams und die Skalierbarkeit der zugrunde liegenden Bio-Plattform waren weitere entscheidende Faktoren.

- Cambrium (Berlin, gegründet 2020): Das Team um Dr. Mitchell Duffy nutzt eine KI-gestützte Designplattform, um neuartige Proteine mit molekularen Funktionen zu entwickeln, die in der Natur so nicht vorkommen. Ihr Fokus liegt auf der Kosmetik- und Textilindustrie, wo sie petrochemische Inhaltsstoffe durch bio-designte Alternativen ersetzen. Mit massiven Finanzierungsrunden, angeführt von Tech-Schwergewichten wie Essential Capital und dem Google-KI-Fonds Gradient Ventures, gilt Cambrium als Leuchtturm für eine neue Generation von Biomaterial-Zulieferern, die aus digitalem Code physische Hochleistungsprodukte erschaffen.

- Bluu Seafood (Berlin, gegründet 2020): Gegründet von Dr. Sebastian Rakers und Simon Fabich, ist Bluu einer der führenden europäischen Akteure im Bereich kultivierter Fisch. Durch die Kultivierung echter Fischzellen im Bioreaktor adressieren sie die Überfischung der Meere. Nach signifikanten Investments durch Lead-Investor Sparkfood sowie LBBW VC und Delivery Hero Ventures steht das Unternehmen kurz vor der ersten Marktzulassung in Singapur und den USA.

- Colipi (Hamburg, gegründet 2022): Das Spin-off der TU Hamburg, geführt von Maximilian Webers, nutzt eine patentierte Gasfermentationstechnologie, um CO2 in nachhaltige Öle und Lipide umzuwandeln. Der USP von Colipi ist die Nutzung von industriellen Abgasströmen als Rohstoff, was die Produktion extrem kosteneffizient macht. Sie konnten sich frühzeitig die Unterstützung von Top-Investoren wie dem High-Tech Gründerfonds (HTGF) und dem Innovationsstarter Fonds Hamburg sichern.

- Kynda (Jelmstorf, gegründet 2019): Ursprünglich als Keen 4 Greens von Daniel MacGowan-von Holstein und Franziskus Schnabel gegründet, bietet Kynda Plug-and-Play-Fermentationssysteme für die Lebensmittelindustrie an. Als B2B-Technologiepartner stellen sie modulare Bioreaktoren und Pilzkulturen bereit, mit denen Hersteller ihre eigenen Produktionsabfälle direkt vor Ort kostengünstig in Mykoproteine umwandeln können. Eine kürzliche 3-Millionen-Euro-Seed-Finanzierung – angeführt vom VC EnjoyVenture und massiv flankiert durch ein strategisches Investment des Geflügel-Giganten PHW-Gruppe – unterstreicht das enorme Skalierungspotenzial dieses Kreislauf-Modells.

- Nosh.bio (Berlin, gegründet 2022): Das Team um Tim Fronzek nutzt Pilzbiomasse als funktionalen Inhaltsstoff für die Lebensmittelindustrie, um Clean-Label-Produkte ohne Zusatzstoffe zu ermöglichen. Der technologische Vorsprung von Nosh.bio liegt in der Geschwindigkeit des Fermentationsprozesses. Frühphasen-Finanzierungen durch Earlybird unterstreichen das hohe Vertrauen in das Skalierungspotenzial.

- Ucaneo (Berlin, gegründet 2022): Das Team um Florian Tiller und Carla Glassl beweist, dass Synthetische Biologie auch beim Direct Air Capture (DAC) den Unterschied macht. Statt energieintensiver chemischer Filter nutzt Ucaneo eine biomimetische Technologie: Sie setzen das Enzym Carboanhydrase ein – eines der schnellsten Enzyme der Natur –, um CO2 bei Raumtemperatur direkt aus der Umgebungsluft zu binden. Mit starken Frühphasen-Finanzierungen durch DeepTech-Fonds wie Nucleus Capital und der US-amerikanischen Grantham Foundation baut Ucaneo derzeit in Berlin-Marienfelde ihre erste industrielle Testanlage auf.

- Insempra (München, gegründet 2021): Das Team um Gründer Jens Klein hat sich zum Ziel gesetzt, die massive Abhängigkeit der globalen Lieferketten von der Petrochemie zu beenden. Über ihre B2B-Technologieplattform nutzen sie Präzisionsfermentation, um maßgeschneiderte Inhaltsstoffe für die Kosmetik-, Lebensmittel- und Textilbranche quasi zu programmieren – von bio-basierten Lipiden und Aromen bis hin zu neuartigen Proteinfasern. Eine hochkarätige Finanzierungsrunde, angeführt von europäischen DeepTech-Schwergewichten wie EQT Ventures und BlueYard Capital, unterstreicht den Anspruch von Insempra, ein globaler industrieller Zulieferer der nächsten Generation zu werden.

Ausblick & Fazit: Der globale Wettlauf

Der Blick über den Tellerrand zeigt: Wir stehen in einem globalen Systemwettbewerb. In den USA treibt die per Executive Order erlassene „National Biotechnology and Biomanufacturing Initiative“ Milliardeninvestitionen in die heimische Infrastruktur, flankiert von Pionieren, die dort und in Frankreich (wie Biomemory) bereits an der Verschmelzung von SynBio und DNA-Datenspeicherung arbeiten. In Asien, insbesondere in China und Singapur, werden derweil regulatorische Hürden in Rekordzeit abgebaut, um die Marktführerschaft bei der Biomanufaktur zu übernehmen. Flankiert wird dies von Hubs wie Israel, die mit massivem VC-Kapital den globalen Markt für kultivierte Proteine dominieren wollen.

Das Fazit für das Jahr 2026: Biologie ist die Infrastruktur der Zukunft. Für Gründer*innen bedeutet dies, dass die Zeit der reinen Plattform-Versprechen vorbei ist; gefragt sind konkrete Produkte und belastbare Unit Economics. Für Investor*innen bietet SynBio die seltene Chance, echte „Impact-Rendite“ zu erzielen, indem sie Industrien transformieren, die über Jahrzehnte festgefahren waren. Wer heute den Code der Natur versteht und skalieren kann, wird die Welt von morgen nicht nur verstehen, sondern neu bauen.

Bootstrapping im LegalTech: Wie cleverklagen den Arbeitsrechtsmarkt aufmischt – und wo die Grenzen des Modells liegen.

LegalTech-Start-ups versprechen den niederschwelligen Zugang zum Recht. Das 2020 von Fabian Beulke und Lucas Rößler gegründete cleverklagen fokussiert sich dabei auf das Arbeitsrecht und will Arbeitnehmer*innen bei Kündigungen sowie Abfindungen unterstützen. Die Besonderheit: Das Gründer-Duo wächst im Gegensatz zu vielen Wettbewerber*innen profitabel und das gänzlich ohne Investor*innen. Doch in einem hart umkämpften Markt stellt sich die Frage, wie nachhaltig das provisionsbasierte Geschäftsmodell und der technologische Vorsprung wirklich sind.

Der Markt für verbraucherorientiertes LegalTech (B2C) hat in den vergangenen Jahren in Deutschland stark an Fahrt aufgenommen. Im Zentrum stehen oft standardisierbare Massenverfahren – von Fluggastrechten über Mietminderungen bis hin zum Arbeitsrecht. In letzterem Segment positioniert sich cleverklagen.

Bootstrapping in einem teuren Markt

Gegründet wurde die Plattform im Jahr 2020 von den beiden Rechtsanwälten Fabian Beulke und Lucas Rößler. Die Idee entstand in ihrer gemeinsamen Zeit bei der renommierten Kanzlei Hausfeld LLP, wo sie maßgeblich in die Betreuung großer Sammelklagen involviert waren. Diese Erfahrung inspirierte das Duo zu einem Ansatz, den sie selbst als eine Art „Robin Hood Litigation“ beschreiben: Sie wollen die strukturellen Nachteile von Arbeitnehmer*innen gegenüber ressourcenstarken Unternehmen ausgleichen. Dabei positioniert sich das Start-up bewusst als moderne Alternative zur klassischen Kanzlei.

Bemerkenswert für die Start-up-Szene: cleverklagen wächst seit der Gründung profitabel und verzichtet dabei vollständig auf externes Kapital. Das ist mutig. Denn im B2C-Arbeitsrecht haben Kund*innen einen extrem niedrigen Lifetime Value – man wird idealerweise nur einmal gekündigt –, während die Akquisekosten via Google Ads enorm sind. Wie stemmt man das gegen VC-finanzierte Konkurrenz?

„Wir haben bewusst klein angefangen“, blickt Lucas Rößler zurück. „Gerade beim Bootstrapping kommt es darauf an, extrem effizient und genau zu arbeiten. Denn wenn das Geld knapp ist, kann man sich nur wenige Fehler leisten“, erinnert er sich an die harte Anfangsphase, in der das Duo nahezu alles selbst übernehmen musste. Fehlerverzeihlich ist das B2C-Arbeitsrecht bis heute nicht: Wer im Google-Ads-Wettbewerb gegen VC-finanzierte Player antritt, braucht Nerven aus Stahl – und, wie Rößler anmerkt, „einen starken Sales-Funnel, von der Anzeige bis zur Conversion“. Neben dieser technischen Präzision brauche es laut dem Gründer aber auch „sehr viel Liebe fürs Detail und ein gutes Verständnis, was die Kund*innen von einem erwarten“. Ob sich ein(e) einzelne(r) Mandant*in rechne, müsse man in der Summe betrachten. Dank erfahrener Anwält*innen sei man meist erfolgreich, was dem Unternehmen heute eine finanzielle Stabilität gebe, die in der Anfangsphase gefehlt habe.

Prozesskostenfinanzierung statt Stundenlohn

Die Geschäftsidee verknüpft digitale Prozessabläufe mit der Betreuung durch echte Jurist*innen. Eine eigens entwickelte Software soll Arbeitsabläufe vereinfachen und dem Team mehr Raum für die Mandant*innenbetreuung geben. Das Kernstück ist jedoch das finanzielle Modell, das einer klassischen Prozesskostenfinanzierung entspricht: Es gibt kein Vorkostenrisiko und im Falle einer Niederlage entstehen den Arbeitnehmer*innen keine Kosten. Verfügen die Kund*innen über keine Rechtsschutzversicherung, finanziert cleverklagen den Prozess vor. Im Gegenzug wird eine Provision fällig, die als Teil der zusätzlich ausgehandelten Abfindung beschrieben wird.

Doch wie hoch ist diese Erfolgsprovision genau? „Unsere Erfolgsprovision ist bewusst nicht einheitlich festgelegt, sondern hängt immer vom jeweiligen Fall ab“, erklärt Fabian Beulke. Man berücksichtige das Verlustrisiko, die übernommenen Anwaltskosten und die realistische Abfindungshöhe. „Durchschnittlich kann man sagen, dass unser Erfolgshonorar bei knappen 30 Prozent liegt“, präzisiert Beulke. Stehe eine sehr hohe Abfindung im Raum, könne die Provision auch deutlich darunter fallen – bei hohem Risiko aber auch entsprechend steigen.

Während sich das Duo bei der Erfolgsquote auskunftsfreudig zeigt – derzeit schließe man über 90 Prozent der Fälle erfolgreich ab und wachse jährlich um rund 50 Prozent –, mauern die beiden bei der Frage nach den genauen Finanzen. „Zu konkreten Umsatzzielen äußern wir uns allerdings nicht“, wiegelt Beulke ab.

Das „Rosinenpickerei“-Dilemma

Das Modell der Prozessfinanzierung ist lukrativ, steht bei Kritikerinnen aber oft unter dem Verdacht des sogenannten Cherry-Pickings. Der Vorwurf lautet, Anbieter*innen würden durch Algorithmen rigoros vorfiltern und nur die fast risikolosen Fälle annehmen, während komplexe oder wirtschaftlich kleinere Schicksale durchs Raster fallen.

Lucas Rößler wehrt sich vehement gegen diese Darstellung: „Diese Kritik können wir so nicht bestätigen. Unsere Ablehnungsquote ist sehr niedrig, denn wir wollen so vielen Menschen wie möglich helfen.“ Zwar bleibt Rößler eine exakte Prozentzahl bei der Ablehnungsquote schuldig, verspricht aber: „Uns ist es ganz egal, ob unser(e) Mandant*in Mini-Jobber*in oder eine hochbezahlte Führungskraft ist. Auch komplexere oder risikoreichere Fälle schließen wir nicht aus.“ Abgelehnt werde laut Rößler nur bei Anfragen, die den eigenen moralischen Werten widersprechen – oder „wenn kein Anspruch oder Verhandlungshebel gegen den bzw. die Arbeitgeberin vorliegt“. Robin Hood agiert im LegalTech-Markt eben auch mit wirtschaftlichem Kalkül.

Proprietäre Software vs. Standard-KI

Cleverklagen betont medial gern den Einsatz eigener Tech- und KI-Lösungen. Doch in Zeiten, in denen sich standardisierte juristische Branchen-KIs rasant entwickeln, wird eine eigene Fallbearbeitungs-Software zunehmend zum reinen Hygienefaktor und verliert als unüberwindbarer Wettbewerbsvorteil an Strahlkraft.

Wo genau zieht das Start-up also die technische Grenze zwischen Automatisierung und anwaltlichem Handwerk? „Künstliche Intelligenz soll unsere Anwält*innen in erster Linie bei repetitiven und administrativen Aufgaben unterstützen“, ordnet Fabian Beulke ein. Es gehe vor allem um Fristen- und Aufgabenmanagement, Terminplanung oder die Dokumentenverwaltung. Dabei setze man auf hohe Datenschutzstandards: Die hauseigene KI laufe ausschließlich auf eigenen Servern, gänzlich ohne externe Datenverbindungen. Zudem durchkämme die KI laufend die Akten für Konsistenz-Checks. Ein pragmatischer statt revolutionärer Ansatz, wie Beulke unumwunden zugibt: „Das ist wichtig, damit bei der Vielzahl laufender Fälle nichts daneben geht.“

Bei der juristischen Kernarbeit zieht Beulke jedoch eine klare rote Linie: „Uns ist wichtig, dass eine Entscheidung nie von der KI getroffen wird. Diese Verantwortung liegt ausschließlich bei unseren Anwält*innen.“ Gerade das Arbeitsrecht sei viel Verhandlungssache, die oft mündlich in persönlichen Gesprächen oder vor Gericht geklärt werde. „Es braucht ein starkes Verhandlungsgeschick, Erfahrung und das richtige Timing“, so der Mitgründer. „Das kann KI aus unserer Sicht nicht ersetzen.“

Fazit & Ausblick

Cleverklagen zeigt eindrücklich, dass gesundes Wachstum ohne Investorinnen auch im anwaltlichen Dienstleistungssektor funktionieren kann. Die eigentliche Herausforderung für das Duo dürfte künftig jedoch weniger in der hauseigenen Softwareentwicklung liegen, sondern in der profitablen und skalierbaren Kund*innenakquise.

Wo sieht sich das Unternehmen in zwei Jahren? Lucas Rößler hat klare finanzielle Ambitionen: „Wenn weiterhin alles gut läuft, haben wir unseren Umsatz und Gewinn in zwei Jahren idealerweise mehr als verdoppelt.“ Ob man die vertikale Marktführerschaft im Arbeitsrecht erzwingen könne, werde sich zeigen.

Interessant ist jedoch die strategische Ausrichtung für die Zukunft: Cleverklagen plant die Expansion in weitere Rechtsgebiete. Dabei wolle man sich explizit nicht auf standardisierte Massenverfahren fokussieren, verrät Rößler: „Wir wollen Rechtshilfe in Bereichen bieten, in denen Menschen echte und oft existenzielle Unterstützung benötigen. Zum Beispiel bei Streitigkeiten mit Versicherungen oder bei familien- oder erbrechtlichen Fragen.“

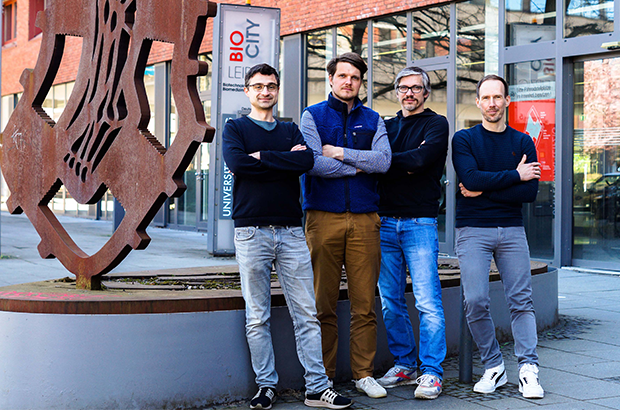

ESTER Biotech: Vom Friedhofskompost zur Plastik-Revolution

Ein Enzym vom Leipziger Südfriedhof soll das weltweite Plastikproblem lösen. Das 2025 als Uni-Spin-off gegründete Start-up ESTER Biotech verspricht, schwer recycelbares PET in Rekordzeit in seine Grundbausteine zu zerlegen. Doch auf dem Weg vom Labor in die industrielle Skalierung warten das berüchtigte „Valley of Death“ – und ein scheinbar übermächtiger Konkurrent.

Der Ursprung einer potenziellen industriellen Revolution liegt ausgerechnet auf einem Komposthaufen des Leipziger Südfriedhofs. Hier suchten Forschende der Universität Leipzig gezielt nach Mikroorganismen zur Zersetzung pflanzlicher Biopolymere und stießen auf das Enzym PHL7. Was in vielbeachteten Publikationen begann, mündete im Frühjahr 2025 in der offiziellen Ausgründung der ESTER Biotech GmbH.

Das Gründer-Quartett um die Geschäftsführer Dr. Ronny Frank und Martin Hirschfeld, den wissenschaftlichen Kopf Dr. Christian Sonnendecker (der das Enzym maßgeblich mitentdeckte) sowie den verfahrenstechnischen Leiter Madalin Ceausescu hat ein klares Ziel: das chemisch-biologische Recycling von Kunststoffen auf ein neues Level zu heben. Möglich machte diesen Schritt eine millionenschwere exist-Forschungstransfer-Förderung.

Für klassische Investor*innen sei die frühe Laborphase technologisch meist noch zu riskant, erklärt Christian Sonnendecker. Genau hier setzte das Programm an: „Der exist-Forschungstransfer hat für uns die Lücke zwischen akademischem Proof-of-Concept und einem investierbaren DeepTech-Start-up geschlossen“, betont der Gründer. „Wir konnten den Recyclingprozess vom Labormaßstab von einem Liter auf 100 Liter skalieren, neue Konzepte realisieren und das Verfahren validieren.“

Was passiert im Bioreaktor mit schmutzigem Müll?

Das technologische Versprechen ist enorm: Das modifizierte Enzym zerlegt selbst schwer recycelbares PET – wie Multilayer-Verpackungen – bei moderaten 65 Grad Celsius und Reaktionszeiten von unter 6 Stunden. Daraus kann neuwertiges, lebensmittelechtes Plastik entstehen. Doch wie reagiert das System in der Realität auf stark kontaminierten Haushaltsmüll? „Wir haben bislang keinen echten Show-Stopper gesehen“, sagt Sonnendecker pragmatisch. Er verzichtet auf romantische Labor-Illusionen und ordnet die Fakten nüchtern ein: „Enzyme gelten als empfindlich, aber in der Praxis arbeiten sie erstaunlich resilient. In den typischen Abfallfraktionen, die wir getestet haben, führen Störstoffe aus Haushaltsverpackungen nicht zu kritischen Aktivitätsverlusten.“

Der tatsächliche Flaschenhals sei nicht die Biologie, sondern die Wirtschaftlichkeit: „Je stärker eine Abfallfraktion kontaminiert ist, desto geringer die Ausbeuten, begleitet mit höherem Aufwand bei Aufarbeitung und Reinigung der Produkte. Das erhöht die Kosten.“

Ein patentierter Moat – mehr als nur ein KI-Hype

Um die Enzyme rasant an neue Herausforderungen anzupassen, nutzt ESTER eine patentierte, KI-gestützte Screening-Technologie. Ist das ein echter Schutzwall gegen gut finanzierte BioTech-Labore in Asien oder den USA? Sonnendecker relativiert den reinen Algorithmus-Hype mit einem treffenden Vergleich: „KI ist heute kein exklusives Werkzeug mehr. Als Schreiben zugänglich wurde, bedeutete das nicht, dass plötzlich jeder ein guter Autor war.“

Der wahre Moat („Burggraben“) liege vielmehr in der eigenen Hardware und der Datenqualität: „Unser patentierter Ansatz basiert auf einer Messmethode, die den Kunststoff mittels Elektrizität selbst beobachtet. Dadurch erhalten wir multiparametrische und hochqualitative Daten. Der eigentliche Moat entsteht deshalb nicht durch ein einzelnes ‚Superenzym‘, sondern durch die integrierte Plattform und den Blick auf das Große.“

Regulatorik als Treiber

Der globale Markt für recyceltes PET (rPET) wird aktuell auf rund 5 Millionen Tonnen beziffert. Angetrieben wird das Wachstum durch strenge EU-Vorgaben (PPWR), die ab 2026 greifen und das Ende des billigen Neu-Plastiks einläuten. Aber was passiert, wenn Plastik aus Erdöl politisch geduldet und weiterhin deutlich billiger bleibt? „Natürlich ist Neu-Plastik aus Erdöl in vielen Fällen günstiger“, räumt Sonnendecker ein. „Aber dieser Preisvorteil basiert auf einer von fossilen Ressourcen abhängigen, linearen Wertschöpfungskette – also einer Sackgasse.“

Deutlicher wird der Gründer beim Blick auf die Konkurrenz. Der französische Marktführer Carbios bindet bereits Giganten wie L'Oréal oder Nestlé an sich. Droht ESTER den Anschluss zu verlieren? „Wir beäugen die Entwicklung von Carbios mit Skepsis“, teilt Sonnendecker selbstbewusst aus.

Tatsächlich geriet der Branchenprimus zuletzt ins Straucheln: Anfang 2025 kündigte Carbios einen drastischen Stellenabbau an, der Bau der ersten industriellen Anlage im französischen Longlaville musste aus Finanzierungsgründen auf 2028 verschoben werden. Stattdessen fokussieren sich die Franzosen nun auf ein Joint Venture mit dem chinesischen PET-Hersteller Wankai, um ab 2026 eine Anlage in Asien hochzuziehen.

Für Sonnendecker ein klares strategisches Warnsignal: „Wir sehen hier die Gefahr, dass europäische Technologie abwandert und genau jene industrielle Resilienz in Europa nicht entsteht, die so wichtig für unsere Unabhängigkeit wäre.“ Der Mitgründer ergänzt: „Weiterhin geht uns Carbios nicht weit genug, denn die Technologie bietet noch viel mehr. Wir konzentrieren uns gezielt auf bislang nicht verwertbare PET-Ströme, die heute in der Verbrennung landen und wollen in Synergie mit mechanischen Recyclern gehen. Und dabei ist PET nur der Anfang: Unser Ziel ist es, aktiv die Kunststoffwelt von morgen mitzugestalten, indem wir unsere Technologien bei der Entwicklung neuer Kunststoffe nach dem Prinzip Design for Circularity ins Spiel bringen. Wir setzen dabei auf die Werkzeuge der Natur, Enzyme, um zukunftsfähige Lösungen skalierbar zu machen und der nächsten Generation von Kunststoffen den Weg in den Markt zu ebnen.“

Die unweigerliche Millionenfrage

ESTER positioniert sich als Angreifer, doch im Jahr 2026 beginnt die kritische Phase. Der Sprung in den industriellen Dauerbetrieb ist in der Biotechnologie historisch extrem kapitalintensiv – das klassische „Valley of Death“. Da die öffentlichen Fördermittel auslaufen, sind nun echte Venture-Capital-Millionen gefragt. Wie will das Start-up überleben, ohne direkt die Mehrheit an Großinvestor*innen abgeben zu müssen?

„Für uns ist entscheidend, nicht in die klassische Falle zu laufen, alles auf eine kapitalintensive eigene Anlage zu setzen“, erklärt der Gründer seine Strategie. Demonstrations- und Pilotanlagen würden lieber angemietet statt selbst gebaut. „Das reduziert den Kapitalbedarf in dieser kritischen Phase erheblich.“ Für die anstehenden Verhandlungen mit großen VC-Fonds zeigt er sich kompromisslos: „Wir kommen nicht aus einer Position des Zwangs, sondern mit validierter Technologie, ersten Umsätzen, starken Partnern und klaren Skalierungspfaden.“

Ist Florian Bretschneider seriös? Kundenberichte, Bewertungen und Hintergrund Einleitung

Wer sich über Online-Business oder neue digitale Tätigkeiten informiert, möchte häufig vorab einschätzen, wie seriös ein Anbieter ist und welche Erfahrungen andere gemacht haben. Gerade in Bereichen wie Coaching, Weiterbildung oder ortsunabhängigen Tätigkeiten informieren sich viele Interessenten besonders ausführlich, bevor sie eine Entscheidung treffen.

Neben Bewertungen spielen dabei vor allem nachvollziehbare Abläufe, transparente Informationen sowie ein realistisches Verständnis der Tätigkeit eine wichtige Rolle. Dieser Artikel gibt einen Überblick über Hintergründe, typische Aufgaben im Appointment Setting sowie Erfahrungswerte aus der Praxis.

Welche Tätigkeit steckt hinter Appointment Setting?

Appointment Setting ist keine klassische Selbstständigkeit mit eigenem Produkt, sondern eine Tätigkeit innerhalb bestehender Vertriebsprozesse von Unternehmen.

Typische Aufgaben sind:

- Bearbeitung eingehender Anfragen über digitale Kanäle anhand klar definierter Abläufe

- Einordnung, ob Anfragen grundsätzlich zum jeweiligen Angebot passen (Vorqualifizierung)

- Koordination und Terminvereinbarung für Beratungsgespräche innerhalb bestehender Systeme

- Unterstützung im Vertriebsprozess durch strukturierte Vorbereitung von Gesprächsterminen

Die Tätigkeit folgt in der Praxis meist strukturierten Prozessschritten, damit Anfragen nachvollziehbar eingeordnet und Termine sinnvoll koordiniert werden können.

Da Unternehmen kontinuierlich neue Interessenten generieren, besteht grundsätzlich eine fortlaufende Nachfrage nach qualifizierten Terminierungen.

Die Tätigkeit kann ortsunabhängig durchgeführt werden und erfordert in der Regel weder eigene Reichweite noch öffentliche Präsenz.

Beispiele für Erfahrungen aus der Praxis

Einige Erfahrungsberichte beziehen sich auf erste praktische Schritte im Bereich digitaler Terminierungsprozesse. Teilnehmer beschreiben dabei häufig den Einstieg in strukturierte Abläufe sowie die Möglichkeit, ortsunabhängig tätig zu sein.

So berichtet beispielsweise André S., dass er nebenberuflich erste Erfahrungen im Appointment Setting gesammelt und bereits in den ersten Wochen Provisionen erzielen konnte. Auch Teilnehmer wie Alice Z. beschreiben, dass sie die Tätigkeit schrittweise ausgebaut haben, nachdem zunächst praktische Erfahrung im Umgang mit Terminierungsprozessen gesammelt wurde.

Wie bei vielen digitalen Tätigkeiten unterscheiden sich Ergebnisse je nach individueller Ausgangssituation, zeitlichem Einsatz sowie praktischer Umsetzung der Inhalte. Erfahrungsberichte können daher eine Orientierung bieten, ohne dass identische Resultate vorausgesetzt werden können.

Einordnung von Erfahrung und Bewertungen

Florian Bretschneider beschäftigt sich seit mehreren Jahren mit digitalen Vertriebsprozessen und Appointment Setting im Coaching- und Beratungsumfeld. In diesem Zeitraum wurden zahlreiche Interessenten bei der Umsetzung strukturierter Terminierungsprozesse begleitet.

Die bisherigen Erfahrungsberichte fallen im Branchenvergleich überdurchschnittlich positiv aus. Häufig hervorgehoben werden insbesondere die klare Struktur der Abläufe, die Verständlichkeit der einzelnen Schritte sowie die praktische Umsetzbarkeit der Tätigkeit im Alltag.

Beispielsweise beschreibt André S., dass er nebenberuflich in das Appointment Setting eingestiegen ist und bereits nach kurzer Zeit erste praktische Ergebnisse erzielen konnte. Auch Teilnehmer wie Alice Z. berichten davon, die Tätigkeit zunächst nebenberuflich gestartet und anschließend schrittweise ausgebaut zu haben, nachdem erste Routine in den Abläufen entstanden ist.

Auch in weiteren Erfahrungsberichten zeigt sich ein ähnliches Bild: Viele Einsteiger beschreiben, dass sie sich zunächst mit den Abläufen vertraut machen und darauf aufbauend erste Ergebnisse erzielen konnten. Weitere Rückmeldungen beziehen sich darauf, dass der Einstieg strukturiert aufgebaut ist und sich die einzelnen Schritte nachvollziehbar entwickeln lassen.

Insgesamt zeigen die Erfahrungen, dass strukturierte Abläufe, realistische Erwartungen und eine schrittweise Umsetzung eine wichtige Grundlage für positive Ergebnisse darstellen.

Transparenz und nachvollziehbare Abläufe

Ein wichtiger Faktor für die Einschätzung der Seriosität ist, ob Inhalte und Abläufe verständlich dargestellt werden. Interessenten möchten vorab nachvollziehen können:

- wie eine Tätigkeit grundsätzlich aufgebaut ist

- welche Aufgaben übernommen werden

- welche Voraussetzungen sinnvoll sein können

- wie die praktische Umsetzung erfolgt

Je klarer Prozesse beschrieben sind, desto leichter lässt sich einschätzen, ob ein Modell zur eigenen Situation passt.

Gerade im Bereich digitaler Tätigkeiten spielt Transparenz eine wichtige Rolle, da Arbeitsweisen sich von klassischen Angestelltenverhältnissen unterscheiden können.

Für wen Appointment Setting geeignet ist – und für wen nicht

Wie bei jeder Tätigkeit ist auch dieses Modell nicht für jede Person gleichermaßen geeignet.

Geeignet kann es sein für:

- Personen mit Interesse an Online-Business

- strukturierte Arbeitsweise

- Interesse an digitalen Geschäftsmodellen

- Wunsch nach ortsunabhängigem Arbeiten

Weniger geeignet kann es sein für:

- Personen, die kein Interesse am Austausch mit Interessenten haben

- Personen, die ausschließlich passives Einkommen erwarten

- Personen ohne Bereitschaft, neue Fähigkeiten zu erlernen

Eine realistische Erwartungshaltung ist entscheidend für eine positive Erfahrung.

Hintergrund und Einordnung der Tätigkeit

Appointment Setting ist ein Bestandteil moderner Vertriebsprozesse, bei denen Unternehmen digitale Kanäle nutzen, um Interessenten strukturiert zu betreuen.

Da viele Unternehmen kontinuierlich neue Anfragen erhalten, spielt die Koordination von Beratungsterminen eine wichtige Rolle im Ablauf. Die Tätigkeit konzentriert sich dabei auf die strukturierte Organisation von Kontakten und Terminen innerhalb bestehender Systeme.

Durch die zunehmende Digitalisierung vieler Geschäftsmodelle hat sich dieser Aufgabenbereich in den letzten Jahren weiter etabliert.

Fazit: Seriosität im Kontext digitaler Tätigkeiten richtig einordnen

Die Einschätzung der Seriosität hängt im Bereich Online-Business häufig davon ab, wie transparent Inhalte dargestellt werden und wie nachvollziehbar Abläufe aufgebaut sind.

Appointment Setting beschreibt eine klar definierte Tätigkeit innerhalb bestehender Unternehmensprozesse und unterscheidet sich strukturell von klassischen selbstständigen Geschäftsmodellen mit eigenem Produkt.

Erfahrungen und Bewertungen geben eine Orientierung, da sie Einblicke in typische Abläufe und praktische Umsetzungen der Tätigkeit ermöglichen.

Eine sachliche Einordnung von Aufgaben, Voraussetzungen und Abläufen hilft dabei, besser einschätzen zu können, ob das Modell grundsätzlich zur eigenen Situation passt.

MANA: Wie Virtual Office Services den Unternehmensalltag neu strukturieren

Ein detailliertes Portrait von MANA: Virtual Office, digitale Prozesse und persönliche Betreuung für Start-ups und KMU.

Die Arbeitswelt hat sich in den vergangenen Jahren grundlegend verändert. Flexible Arbeitsmodelle, digitale Prozesse und ortsunabhängiges Arbeiten sind längst keine Ausnahme mehr, sondern prägen den Alltag vieler Unternehmen. Gleichzeitig stehen insbesondere Start-ups, Selbstständige und kleine Unternehmen vor der Herausforderung, administrative Aufgaben effizient zu organisieren, ohne dabei wertvolle Ressourcen zu verlieren.

Genau an dieser Schnittstelle setzt MANA an. Das Unternehmen positioniert sich als zentraler Ansprechpartner für organisatorische Prozesse im Hintergrund – mit dem Ziel, den Geschäftsalltag einfacher, strukturierter und digitaler zu gestalten. Weitere Informationen zum Leistungsangebot und zur Struktur des Unternehmens finden sich unter https://we-are-mana.com/.

Von der Idee zur Lösung: Warum MANA entstanden ist

Wer gründet, konzentriert sich zunächst auf Produkt, Markt und Wachstum. Doch schnell wird deutlich, dass administrative Aufgaben einen erheblichen Teil der täglichen Arbeit ausmachen. Posteingang, Dokumentenmanagement oder rechtliche Anforderungen gehören zu den grundlegenden Pflichten – sind jedoch selten der eigentliche Fokus eines Unternehmens.

Gerade in kleinen Teams oder bei Einzelunternehmen entstehen dadurch typische Herausforderungen:

- fehlende Zeit für organisatorische Aufgaben

- unklare Abläufe im Umgang mit Dokumenten

- Unsicherheiten bei rechtlichen Anforderungen

- mangelnde Struktur im Tagesgeschäft

MANA setzt genau hier an und verfolgt einen Ansatz, der diese Prozesse bündelt und vereinfacht. Ziel ist es, Unternehmen von administrativen Aufgaben zu entlasten, ohne dass diese eigene Strukturen aufbauen müssen.

Virtual Office neu definiert

Das Konzept des Virtual Office ist grundsätzlich bekannt, wird jedoch häufig auf die Bereitstellung einer Geschäftsadresse reduziert. MANA erweitert diesen Ansatz um digitale und organisatorische Komponenten, die über klassische Angebote hinausgehen.

Im Zentrum stehen dabei:

- eine ladungs- und handelsregisterfähige Geschäftsadresse

- ein strukturierter Postservice

- digitale Bereitstellung eingehender Dokumente

Alle eingehenden Sendungen werden digitalisiert und online zur Verfügung gestellt – in vielen Fällen noch am Tag des Eingangs. Dadurch entsteht ein jederzeit verfügbarer Überblick über wichtige Unterlagen. Originaldokumente können bei Bedarf zuverlässig weitergeleitet werden.

Diese Kombination ermöglicht es Unternehmen, ortsunabhängig zu arbeiten und gleichzeitig alle formalen Anforderungen zu erfüllen.

Persönliche Betreuung als zentraler Unterschied

Ein wesentliches Merkmal von MANA ist der persönliche Ansatz. Während viele Anbieter auf standardisierte Prozesse und automatisierte Abläufe setzen, legt das Unternehmen Wert auf direkte Ansprechpartner und individuelle Betreuung.

Das zeigt sich insbesondere in:

- persönlicher Kommunikation statt anonymem Support

- festen Ansprechpartnern für individuelle Anliegen

- schnellen und nachvollziehbaren Lösungen

Diese Struktur schafft Vertrauen und sorgt dafür, dass Kunden nicht als Nummer behandelt werden. Gerade für kleinere Unternehmen kann dieser persönliche Kontakt ein entscheidender Faktor sein.

Berlin im Fokus – Expansion in weitere Städte

Der aktuelle Schwerpunkt von MANA liegt auf Berlin. Als einer der wichtigsten Gründerstandorte Europas bietet die Stadt ideale Voraussetzungen für junge Unternehmen und innovative Geschäftsmodelle.

Eine Geschäftsadresse in Berlin kann dabei nicht nur formale Vorteile bieten, sondern auch die Außenwirkung eines Unternehmens stärken.

Gleichzeitig ist die Expansion bereits geplant:

- München als nächster zentraler Standort

- perspektivische Erweiterung nach Hamburg und Frankfurt

Diese Entwicklung zeigt, dass das Modell skalierbar ist und sich an unterschiedliche Märkte anpassen lässt.

Digitale Prozesse als Fundament

Ein zentraler Bestandteil des Konzepts ist die konsequente Digitalisierung administrativer Abläufe. Prozesse, die traditionell zeitintensiv und papierbasiert sind, werden hier strukturiert und vereinfacht.

Dazu gehören unter anderem:

- digitale Erfassung und Archivierung von Dokumenten

- ortsunabhängiger Zugriff auf Post und Unterlagen

- klare Strukturierung von Geschäftsprozessen

Der Vorteil liegt in der Transparenz: Unternehmen behalten jederzeit den Überblick über ihre Dokumente und können schnell auf relevante Informationen zugreifen.

Flexible Nutzung von Meetingräumen

Neben den digitalen Services bietet MANA die Möglichkeit, Meetingräume bei Bedarf zu nutzen. Diese können flexibel gebucht werden und eignen sich für unterschiedliche Einsatzbereiche:

- Kundentermine

- Präsentationen

- interne Besprechungen

Dadurch entsteht eine Kombination aus digitaler Flexibilität und physischer Infrastruktur – ohne langfristige Verpflichtungen für feste Büroflächen.

Für wen das Modell besonders geeignet ist

Das Angebot von MANA richtet sich vor allem an Unternehmen, die flexibel arbeiten und gleichzeitig professionelle Strukturen benötigen.

Dazu zählen insbesondere:

- Start-ups in der Aufbauphase

- Selbstständige und Freelancer

- kleine und mittlere Unternehmen

Besonders relevant ist das Modell für Unternehmen, die keine eigenen Büroräume benötigen oder bewusst auf flexible Lösungen setzen. Gleichzeitig profitieren alle, die administrative Prozesse auslagern möchten, ohne die Kontrolle zu verlieren.

Einordnung im Wettbewerbsumfeld

Der Markt für Virtual Offices wächst seit Jahren kontinuierlich und wird zunehmend vielfältiger. Zahlreiche Anbieter positionieren sich mit ähnlichen Grundangeboten, unterscheiden sich jedoch deutlich in ihrer Umsetzung, ihrem Serviceverständnis und ihrer Zielgruppenansprache. Während viele Lösungen stark standardisiert und auf Skalierung ausgelegt sind, zeigt sich bei genauerem Hinsehen, dass nicht alle Anbieter denselben Anspruch an Betreuung und Struktur verfolgen.

MANA wählt hier bewusst einen differenzierten Ansatz. Im Fokus stehen nicht allein digitale Prozesse, sondern deren Kombination mit persönlicher Betreuung und klar nachvollziehbaren Abläufen. Statt anonymer Massenabwicklung setzt das Unternehmen auf direkte Ansprechpartner und eine Zusammenarbeit, die stärker auf individuelle Anforderungen eingeht.

Das zeigt sich insbesondere in:

- dem Fokus auf persönliche Betreuung statt standardisierter Prozesse

- der Verbindung aus digitaler Infrastruktur und individueller Unterstützung

- klar strukturierten, verständlichen Abläufen ohne unnötige Komplexität

Diese Ausrichtung spricht vor allem Unternehmen an, die neben Effizienz auch Wert auf Verlässlichkeit, Transparenz und direkte Kommunikation legen. Gerade für kleinere Unternehmen und Gründer kann dieser Ansatz einen spürbaren Unterschied im Alltag machen.

In einem Interview von MANA mit business-on wird zudem deutlich, wie stark der Fokus auf praxisnahe Lösungen und persönliche Zusammenarbeit gelegt wird – insbesondere mit Blick auf die Bedürfnisse kleiner und wachsender Unternehmen.

Skalierbarkeit und Zukunftsperspektiven

Das Konzept von MANA ist darauf ausgelegt, mit den Anforderungen moderner Unternehmen mitzuwachsen. Gerade in einem Umfeld, das zunehmend von Digitalisierung, Flexibilität und dynamischen Geschäftsmodellen geprägt ist, gewinnen skalierbare Lösungen an Bedeutung. Unternehmen benötigen Strukturen, die sich anpassen lassen – sowohl in frühen Gründungsphasen als auch im weiteren Wachstum.

Digitalisierung, Automatisierung und ortsunabhängige Arbeitsmodelle werden dabei weiterhin eine zentrale Rolle spielen. Lösungen wie die von MANA greifen genau diese Entwicklung auf, indem sie administrative Prozesse vereinfachen und gleichzeitig flexibel erweiterbar bleiben.

Mögliche Entwicklungen umfassen:

- den weiteren Ausbau digitaler Services und automatisierter Abläufe

- die Erweiterung auf zusätzliche Städte und wirtschaftlich relevante Standorte

- die kontinuierliche Optimierung der Nutzererfahrung und Prozessstruktur

Gleichzeitig bleibt der persönliche Ansatz ein wesentlicher Bestandteil des Modells. Auch im Zuge des Wachstums steht die direkte Betreuung im Vordergrund – ein Aspekt, der insbesondere für kleinere Unternehmen und Gründer eine wichtige Rolle spielt. Die Herausforderung wird darin liegen, Skalierung und persönliche Betreuung langfristig in Einklang zu halten.

Fazit

MANA steht exemplarisch für eine Entwicklung, die viele Unternehmen aktuell betrifft: Administrative Prozesse werden zunehmend ausgelagert und digitalisiert, um Ressourcen zu sparen und Abläufe effizienter zu gestalten. Virtual Office Services entwickeln sich dabei von einer ergänzenden Lösung hin zu einem eigenständigen Organisationsmodell, das sich flexibel in unterschiedliche Unternehmensstrukturen integrieren lässt.

Die Kombination aus ladungsfähiger Geschäftsadresse, digitalem Postservice und persönlicher Betreuung bietet eine klar strukturierte Grundlage für den Unternehmensalltag. Besonders für Start-ups, Selbstständige und kleinere Unternehmen entsteht dadurch ein Umfeld, das sowohl Flexibilität als auch Verlässlichkeit ermöglicht – ohne die Notwendigkeit, eigene komplexe Infrastrukturen aufzubauen.

Mit Blick auf die weitere Entwicklung digitaler Arbeitsmodelle ist davon auszugehen, dass die Nachfrage nach solchen Lösungen weiter steigen wird. Unternehmen, die frühzeitig auf strukturierte, digitale und gleichzeitig persönliche Systeme setzen, schaffen sich damit eine stabile Basis für nachhaltiges Wachstum und langfristige Anpassungsfähigkeit.

Zwischen Bildungsdschungel und digitaler Übersicht: Kann das Münchner Start-up kursmap den Weiterbildungsmarkt knacken?

Der Markt für berufliche Weiterbildung in Deutschland ist riesig, extrem fragmentiert – und für Suchende oft frustrierend unübersichtlich. Dariusz Opitek will das Problem mit seinem Start-up kursmap – einer zentralisierten Plattform – lösen. Ein klassisches Plattform-Modell, das schnelles Wachstum verspricht, aber auch bekannte Fallstricke birgt.

Wer in Deutschland nach einer spezifischen beruflichen Fortbildung sucht, landet schnell in einem Labyrinth aus schlecht gepflegten Websites, PDF-Broschüren und intransparenten Preisstrukturen. Genau in diese Lücke stößt die 2025 in München gegründete kursmap GmbH. Erst kürzlich meldete das Start-up einen Meilenstein: Über 150.000 Kurstermine von Präsenz-, Inhouse- und Online-Schulungen sind laut Unternehmensangaben mittlerweile auf der Plattform gebündelt. Doch ist das Modell tragfähig genug, um sich gegen die etablierten Branchengrößen durchzusetzen?

Hinter kursmap steht Gründer und Geschäftsführer Dariusz Opitek. Seine Motivation entsprang einem klassischen Pain Point: Viele Interessierte wissen schlichtweg nicht, welche qualifizierten Anbieter sich in unmittelbarer Nähe befinden. Mit der Vision, „Weiterbildungen sichtbar, digital und einfach zugänglich zu machen“, brachte Opitek die Plattform an den Start.

Doch eine bloße Aggregation von Daten reicht im heutigen Tech-Umfeld selten aus. Bisher steht der Gründer stark im Vordergrund. Auf die Frage, wer neben ihm im Kernteam stehe, um dieses Mammutprojekt zu stemmen, überrascht Opitek mit einer klaren Ansage: „Kursmap ist aktuell noch eine One-Man-Show, und das bewusst.“ Er agiere als Entwickler, SEO-Stratege und Vertriebler in Personalunion. „Was manche als Schwäche sehen, ist für mich ein Vorteil: kurze Entscheidungswege, keine Overhead-Kosten, maximale Fokussierung“, argumentiert der Gründer.

Um sich gegen gut finanzierte Copycats abzusichern, braucht es allerdings einen technologischen Burggraben. Diesen sieht Opitek im Einsatz künstlicher Intelligenz. Er betont, man baue aktuell ein intelligentes Matching-System, das weit über eine klassische Suchmaske hinausgehe. „Nutzer sollen auf Basis ihrer individuellen Situation, ihrer beruflichen Ziele, dem Standort und den aktuellen Marktentwicklungen die passenden Weiterbildungen vorgeschlagen bekommen“, verspricht er. Nicht die erstbeste Option zähle, sondern die richtige. Opitek fasst den Kern seiner Technologie selbstbewusst zusammen: „Das ist keine Datenbank-Logik, das ist ein persönlicher Weiterbildungsberater, der rund um die Uhr verfügbar ist.“

Die Resterampe-Gefahr: Masse statt Klasse?

Die Marke von 150.000 Terminen ist zweifellos beeindruckend. Erreicht wurde dies, indem kursmap die Einstiegshürden für Anbieter bewusst bei null hält, sodass diese eigenständig Profile anlegen können. Genau hier liegt jedoch das größte Risiko: Marktplätze, die auf pure Quantität setzen, laufen schnell Gefahr, mit veralteten Daten oder unseriösen Angeboten der Coaching-Szene überflutet zu werden.

Wie verhindert das Start-up also, zur unregulierten Resterampe zu verkommen? Opitek wehrt sich vehement gegen den Verdacht mangelnder Kontrolle. „Ein niedriger Einstieg bedeutet nicht, dass wir die Augen verschließen, im Gegenteil“, kontert er. Laut dem Geschäftsführer werden alle Profile laufend überprüft, und es gebe klare Prozesse zum Eingreifen. Dass man auf aufwendige Onboarding-Gespräche oder intransparente Anforderungen verzichtet, sei eine sehr bewusste Entscheidung gewesen. Opitek rechtfertigt diesen Weg: „Das schadet besonders kleinen, oft hervorragenden Anbietern, die schlicht nicht die Kapazitäten für bürokratische Hürden haben.“ Sein Credo für die Plattform lautet daher: „Wer gute Kurse anbietet, soll sofort loslegen können. Qualität muss man sich nicht erzwingen, man muss sie fördern.“

Wer zahlt am Ende die Rechnung?

Das Geschäftsmodell basiert auf der kostenlosen Listung für Anbieter*innen, um zügig ein attraktives Angebot aufzubauen. Das Kalkül: Sobald darüber Leads generiert werden, lassen sich diese künftig über Premium-Modelle monetarisieren. Doch um überhaupt Lernende auf die Plattform zu locken, muss kursmap in Google Ads und im organischen Ranking hart gegen etablierte Portale kämpfen – ein Spiel, das meist massiv Kapital verbrennt.

Finanziert das Start-up diesen teuren Sichtbarkeitskampf aus eigener Kraft, oder braucht es dringend externes Venture Capital (VC)? Opitek setzt auf organisches Wachstum durch SEO. „Hochwertige, relevante Inhalte sind die nachhaltigste Investition, die eine Plattform wie kursmap machen kann“, erklärt er. Sichtbarkeit, die man sich hart erarbeite, sei langlebiger als erkaufte Reichweite. Er räumt zwar ein, ergänzend Google Ads zu nutzen, betont jedoch, dass dies hochgradig selektiv passiere. „Kursmap ist und bleibt bootstrapped“, stellt der Gründer klar. Das zwinge das Unternehmen zur Disziplin. Risikokapital sieht er derzeit eher pragmatisch: „Venture Capital ist für uns kein Ziel, sondern eine Option, die wir nur dann in Betracht ziehen würden, wenn sie uns schneller zu unserem Ziel bringt, nicht als Ersatz für ein funktionierendes Modell.“

Der B2B-Pivot: Raus aus dem Google-Hamsterrad

Kursmap agiert in einem Haifischbecken und tritt gegen Portale wie KURSNET, Semigator oder Tech-Riesen wie LinkedIn Learning an. Deutlich spannender als das margenschwache Vermittlungsgeschäft ist daher die langfristige Vision: Opitek plant B2B-Lösungen, mit denen Unternehmen ihre Weiterbildungsbudgets direkt über kursmap verwalten können. Gelingt dieser Wechsel zum B2B-SaaS-Modell, würde sich das Start-up aus der völligen Abhängigkeit vom Google-Traffic befreien.

Doch warum sollten Personalleiter*innen einem Neuling vertrauen statt auf bewährte Features ihrer HR-Software wie Personio oder Workday zu setzen? Auf die konkrete Frage nach der B2B-Strategie bleibt Opitek bei der technischen Ausführung vage und gibt offen zu: „Wie genau wir ihn gestalten, ob als eigenständiges HR-Tool oder als integriertes Feature für Unternehmen, wird die Marktentwicklung zeigen. Wir sind da ehrlich: Wir testen, lernen und passen uns an.“ Gleichzeitig grenzt er sich aber scharf von großen Suiten ab, die oft die inhaltliche Qualität von Weiterbildungsentscheidungen vernachlässigen würden. „Ein Unternehmen, das diesen Mehrwert für seine Mitarbeitenden spürt, wird kursmap nicht als Konkurrenz zu Personio oder Workday sehen, sondern als sinnvolle Ergänzung“, ist Opitek überzeugt.

Booking.com der Bildung oder teure Illusion?

Kursmap greift ein reales Problem in einem oft digital rückständigen Markt auf. Ob das Start-up langfristig aber das „Booking.com für Fortbildungen“ wird, hängt von rigoroser Qualitätssicherung, effizienter Traffic-Skalierung und der Umsetzung der B2B-Pläne ab.

Bleibt am Ende die Frage nach der Langzeitstrategie: Exit oder Industriestandard? Der Gründer strebt die Spitze im deutschsprachigen Raum an, indem man als „aktiver Partner“ fungiere. Gerade weil KI derzeit ganze Berufsbilder umkrempele, bräuchten Menschen laut Opitek keine bloßen Trefferlisten mehr.

„Kursmap soll genau diese Orientierung geben, datenbasiert, individuell, zukunftsgerichtet“, formuliert Opitek seine Ambition. Sollte dies in Deutschland greifen, schließt er eine Expansion nach Europa nicht aus. Einem unkontrollierten Hype erteilt er zum Schluss jedoch eine deutliche Absage: „Wir denken nicht in Szenarien, sondern in Meilensteinen. Erst liefern, dann skalieren.“

Diingu: Kampf gegen den Fachkräftemangel im Sozialwesen

Das Diingu-Gründerteam aus Frankfurt will den eklatanten Fachkräftemangel im Sozialwesen mit einer digitalen Lern- und Jobplattform bekämpfen. Das Start-up hat namhafte Träger*innen an Bord und spricht nun mit internationalen Investor*innen. Doch wie tragfähig ist das Geschäftsmodell in einem chronisch unterfinanzierten Markt, und wie realistisch sind die europäischen Skalierungsträume? Wir haben nachgefragt.

Wer sich den Pitch von Sahm Shojai, Geschäftsführer der Frankfurter Diingu GmbH, durchliest, spürt schnell den typischen Start-up-Idealismus. Es geht um „konkrete Wirkung“, „soziale Teilhabe“ und die Vision einer „globalen sozialen Infrastruktur“, um weltweit die Lebensrealität von Kindern zu verbessern. Das klingt zweifellos gut im Pitch-Deck für potente VCs. Doch zieht man die schillernde Marketing-Ebene ab, bleibt ein konkretes und weitaus pragmatischeres Kerngeschäft. Diingu ist im Kern eine E-Learning- und Recruiting-Plattform für pädagogische Assistenzkräfte. Es handelt sich um ein klassisches B2B2C-Modell in einer Nische, die von der Digitalisierung bislang stiefmütterlich behandelt wurde.

Vom Bruder-„Frust“ zum Uni-Spin-off

Die Geschichte von Diingu – kurz für Digital Inclusion Guide – beginnt im echten Leben. Der Bruder von Mitgründer Sahm Shojai arbeitete als Schulbegleiter und berichtete von den massiven Herausforderungen in seinem Job. Das grundlegende Problem: Immer mehr ungelernte Quereinsteiger*innen strömen in die soziale Branche, denen es eklatant an fachlicher Einarbeitung, Fortbildungen und Qualitätsstandards mangelt.

Aus diesem Engpass formten Sahm Shojai und seine Mitgründer Felix Kolb und Florian Kranz eine digitale Lösung. Dabei gingen sie methodisch klug vor und holten sich von Beginn an wissenschaftliche Expertise ins Boot. Unter der Mentorenschaft von Prof. Dr. Wolfgang Dworschak vom Lehrstuhl für Pädagogik bei geistiger Behinderung an der Universität Regensburg wurde das Start-up als Ausgründung der Hochschule etabliert. Das sicherte dem Team nicht nur ein exist-Gründerstipendium, sondern 2023 auch den Hochschulgründerpreis sowie den 2. Platz beim Frankfurter Gründerpreis. Die Plattform profitiert stark von diesem Fundament, denn die Inhalte sind keine bloßen Wikipedia-Zusammenfassungen, sondern wissenschaftlich fundierte, praxisnahe Kurse.

Doch wie stellt das Team sicher, dass das akademische Wissen der Uni Regensburg nicht zu theoretisch ist und an der rauen Realität einer überforderten Hilfskraft in einer Brennpunkt-Schule vorbeigeht? „Die Entwicklung der Kursinhalte findet mit sorgfältig ausgewählten Experten und Expertinnen statt“, versichert Shojai. Diese verfügten nicht nur über den nötigen akademischen Bezug, sondern brächten auch umfassende praktische Erfahrung mit. „Wir geben klare Richtlinien für die sprachliche Ausgestaltung der Kurse vor und legen großen Wert darauf, dass der Fokus auf praxisnahen Inhalten liegt“, betont der Gründer.

Um die Theorie-Praxis-Lücke zu schließen, fließen daher neben Fachliteratur vor allem persönliche Praxiserfahrungen in die Entwicklung ein. Zudem belässt es Diingu nicht bei der Uni Regensburg, die primär mit Forschungsarbeiten die Qualität sichert. Man kooperiert laut Shojai ebenfalls mit der LMU München, wo der Schwerpunkt auf formativer Diagnostik und Monitoring-Services liege. „Gemeinsam entwickeln wir beispielsweise aktuell ein KI-Tool, das Verhalten- und Risikoanalysen bei Kindern und Jugendlichen durchführen kann“, kündigt der Geschäftsführer an. Sozialarbeitende sollen dadurch befähigt werden, Kindeswohlgefährdungen besser zu erkennen. „Diese innovativen Services sollen den Arbeitsalltag professionalisieren“, resümiert er.

E-Learning trifft auf Jobbörse

Diingu fungiert als zweiseitiger Marktplatz. Auf der einen Seite stehen Privatpersonen wie Schulbegleitende, Kita-Kräfte oder Familienhelfer*innen. Sie können sich gegen eine monatliche Gebühr von aktuell 15 Euro flexibel über mehr als 70 Online-Kurse zu Themen wie Autismus oder ADHS weiterbilden. Bei Verständnisfragen hilft ein KI-Chatbot. Mit den erworbenen Zertifikaten bauen sich die Nutzer*innen dann ein digitales Profil auf. Auf der anderen Seite stehen die großen Träger wie das DRK, die Johanniter oder die Lebenshilfe. Sie zahlen für jährliche Lizenzen, um ihr bestehendes Personal digital zu schulen, Nachweise zentral zu verwalten und schlichtweg Verwaltungskosten zu sparen.

Hand aufs Herz: Wie viele der ohnehin meist schlecht bezahlten pädagogischen Hilfskräfte zahlen die 15 Euro im Monat wirklich selbst aus eigener Tasche? Und plant Diingu langfristig nicht doch einen kompletten Pivot zum lukrativeren, reinen B2B-Modell? Shojai holt bei dieser Frage etwas weiter aus: Man sei vor rund drei Jahren ursprünglich als reine Lernplattform im B2B-Bereich gestartet. Träger nutzten die Kurse zur Schulung des eigenen Personals. „Mit der Zeit erhielten wir jedoch auch zunehmend Anfragen von Privatpersonen, die sich mit unseren Inhalten weiterbilden möchten, um sich auf einen Job im sozialen Bereich zu bewerben“, blickt er zurück. Daraufhin habe man dasselbe Lernangebot über eine App auch für B2C-Kund*innen geöffnet, um die berufliche Vorqualifizierung zu ermöglichen. Gleichzeitig wurde die Jobplattform gelauncht, um beide Kund*innengruppen zusammenzubringen.

Auf die Skepsis bezüglich der privaten Zahlungsbereitschaft kontert Shojai selbstbewusst: „Das sind Menschen, die einen Job im sozialen Bereich suchen und davon gibt es viele, weil der Fachkräftemangel eine sehr hohe Nachfrage nach beruflicher Weiterbildung erzeugt.“ Er spricht im gleichen Atemzug gar von einer handfesten Marktdisruption. Klassische Fortbildungen zur Schulbegleitung kosteten bei anderen Bildungsträgern schnell zwischen 800 und 1.200 Euro. Dies werde heute meist über Bildungsgutscheine finanziert.

Doch genau hier wittert Diingu seine strategische Chance: „Diese Finanzierung über Bildungsgutscheine wird sich mit der Grundsicherung ab Juli 2026 ebenfalls verändern“, prognostiziert Shojai. Aufgrund des Vermittlungsvorrangs würden die Gutscheine künftig nicht mehr so großzügig vergeben. Diingu hingegen biete Wissen für zahlreiche Berufe bereits ab 15 Euro an. „Mit anderen Worten: Wir haben diesen Markt demokratisiert und Wissen überhaupt erst auf Selbstzahlerbasis bezahlbar gemacht“, stellt er klar. Selbst ohne große Werbung könne man erste bezahlte Abonnements vorweisen. „In den kommenden Monaten planen wir, größere Kampagnen zu launchen und mittelfristig den B2B2C-Weiterbildungsmarkt für soziale Berufe mit unserem Selbstzahler-Konzept und unserem E-Learning-Ansatz zu übernehmen“, gibt sich der Geschäftsführer kämpferisch.

Der eigentliche Clou – und das potenzielle Schwungrad des Geschäftsmodells – ist jedoch die Verzahnung: Träger können über das Diingu-Jobportal direkt auf die vorqualifizierten Privatnutzer zugreifen und diese rekrutieren. Doch die großen Wohlfahrtsverbände gelten oft als extrem schwerfällig in der Digitalisierung. Wie hart war es, Traditionsverbände wie das DRK davon zu überzeugen, ihr Recruiting über ein noch unbekanntes Start-up abzuwickeln? Shojai räumt ein, dass die Anfangszeit kein Selbstläufer war. „Digitalisierung bedeutete für viele im sozialen Bereich vor allem Veränderung“, analysiert er. „Und Veränderungen vermeidet man gern, solange nichts anbrennt.“ Heute punkte man schlichtweg mit einem guten Service zum erschwinglichen Preis, weshalb immer mehr große Träger Diingu ausprobieren wollten. Die Einführung bei den Platzhirschen erfordere natürlich Prozessumstellungen, was aber branchenübergreifend bei Großunternehmen der Fall sei. Dennoch gibt der Gründer zu: „Aber ja, keine Frage: Sales war bisher die größte Herausforderung in diesem Unternehmen.“ Das Geschäftsmodell und die Verkaufsstrategien mussten mehrfach nachgeschärft werden. Heute, so Shojai, sei es aber „deutlich einfacher geworden als noch zu Beginn“.

Markt & Wettbewerb

Der Markt für soziale Dienstleistungen ist riesig, aber extrem komplex. Der Fachkräftemangel ist immens; Träger müssen notgedrungen auf ungelernte Hilfskräfte zurückgreifen, was unweigerlich die Qualität der Betreuung gefährdet. Hier trifft Diingu einen echten Pain Point. Der Wettbewerb besteht derzeit vor allem aus den analogen Akademien der Wohlfahrtsverbände, regionalen Fortbildungsanbietern und stark generalisierten E-Learning-Plattformen. Auch klassische Recruiting-Plattformen mischen mit. Diingu grenzt sich durch die spitze Zielgruppe rund um Inklusion und Schulbegleitung sowie durch die intelligente Kombination aus Qualifizierung und Recruiting ab.

Skalierungsträume vs. Marktrealität

So lobenswert der Ansatz ist, das Geschäftsmodell muss sich im Härtetest einigen kritischen Fragen stellen. Ein massives Problem ist der Markt als regulatorischer Flickenteppich. Diingu spricht aktuell mit Investor*innen, um europaweit zu skalieren, doch das Sozial- und Bildungswesen ist hochgradig lokalisiert. Da sich die Vorgaben für Inklusion in Deutschland bereits von Bundesland zu Bundesland massiv unterscheiden, bedeutet eine europäische Expansion zwingend, dass Fortbildungsinhalte an völlig andere gesetzliche Rahmenbedingungen angepasst werden müssen. Das kostet enorm viel Zeit und verbrennt Kapital.

Wie will Diingu diese gewaltige regulatorische Wand durchbrechen, ohne sich finanziell und personell zu verheben? „Das ist eigentlich die entscheidendste Frage, und genau diese begleitet uns seit fast zwei Jahren“, gibt Shojai offen zu. Mit der Lösung stehe und falle der internationale Erfolg. Die Antwort des Start-ups lautet: Automatisierung. Man entwickle gerade eine zweigeteilte „Kursfabrik“. Eine Abteilung konzipiere kleinere Kurse mithilfe von Künstlicher Intelligenz, die am Ende lediglich von Expert*innen lektoriert und qualitätsgeprüft werden. Dafür habe man eigens eine von AWS geförderte Kooperation zur Entwicklung generativer KI-Anwendungen gestartet, um einen skalierbaren Workflow zu etablieren.

Große und wichtige Kurse bleiben jedoch Handarbeit nach strengen Richtlinien. „KI kommt da nicht hin, und ihr fehlt auch reales Praxiswissen, das nur ausgewählte Expertinnen und Experten mitbringen“, stellt Shojai klar. Diese Zweiteilung bedingt logischerweise extrem hohe Kosten bei der Lokalisierung der Inhalte. Auf die konkrete Frage nach der Finanzierbarkeit bleibt der Gründer allerdings unkonkret. Man habe zwar bereits eine „finanzstrategische Lösung“ erarbeitet, doch Details wolle er zum jetzigen Zeitpunkt noch nicht verraten. Er gibt sich jedoch siegessicher: „Wir glauben, mit diesem hybriden KI-Mensch-Kursentwicklungsansatz einen entscheidenden Wettbewerbsvorteil zu erlangen.“

Gleichzeitig stößt das Modell unweigerlich an die Grenzen der Digitalisierung. Das Start-up wirbt mit einem KI-Guide, in der sozialen Arbeit gilt jedoch unumstößlich das Credo: Beziehung vor Technik. Empathie, Deeskalation und der Umgang mit schwer beeinträchtigten Kindern lassen sich über Klick-Kurse und KI-Chats nur in der grauen Theorie erlernen. Eine reine Digitalisierung der Fortbildung ersetzt keine Praxisbegleitung im wahren Leben.

Abschließend wirft auch das avisierte „Big Picture“ rund um die Vision „Diingu Care“ Fragen auf. Die Ankündigung, künftig weltweit Bildungsprojekte zu unterstützen, wirkt aktuell noch wie ein sehr ambitioniertes PR-Versprechen für Impact-Investor*innen. Für ein Start-up in der vulnerablen Skalierungsphase birgt ein solcher Nebenschauplatz stets die Gefahr, den Fokus auf das stark erklärungsbedürftige DACH-Kerngeschäft zu verlieren.

Lenkt diese noble globale Vision das Team nicht gefährlich vom eigentlichen Überlebenskampf und der schwierigen Marktdurchdringung in Europa ab? „Absolut“, stimmt Shojai überraschend direkt zu. Genau aus diesem Grund bewerbe man das Projekt derzeit weder öffentlich noch bei Investor*innen. „Es steht weder auf der Website noch auf irgendeinem Pitch Deck“, versichert er. Der Fokus liege aktuell ausschließlich auf dem Aufbau eines funktionierenden und stark wachsenden Geschäfts. „Erst wenn wir damit Investoren und auch uns selbst geholfen haben, können wir anfangen, mit Diingu Care anderen zu helfen“, erklärt Shojai sein strategisches Prinzip. Dennoch ist es ihm spürbar ein Anliegen zu betonen, dass Diingu Care keine hohle PR-Phrase sei. Diese globale Infrastruktur für Länder ohne stabile soziale Systeme werde unweigerlich kommen. „Und an diesem Ziel wird sich auch nichts ändern, nur weil es ambitioniert ist“, bekräftigt der Geschäftsführer abschließend. „Denn genau das soll Diingu ausmachen: eine Organisation, die Verantwortung übernimmt.“

Fazit

Diingu ist ein exzellentes Beispiel dafür, wie aus einem echten, greifbaren Alltagsproblem eine kluge SaaS-Lösung entstehen kann. Das Team hat durch die universitäre Anbindung seine Hausaufgaben gemacht und mit über 100 Trägern bereits beachtliche Traction im B2B-Markt erreicht. Der Weg zum europaweiten Skalierungserfolg oder gar zur „globalen sozialen Infrastruktur“ wird jedoch steinig. VCs werden künftig genau prüfen, ob die Margen im chronisch klammen Sozialsektor ausreichen und ob der stark regulierte Bildungsmarkt schnelle geografische Sprünge überhaupt zulässt. Diingu muss jetzt beweisen, dass es nicht nur ein nützliches Werkzeug für deutsche Wohlfahrtsverbände bietet, sondern das Zeug zu einem hochprofitablen, grenzüberschreitenden Plattformgeschäft hat.

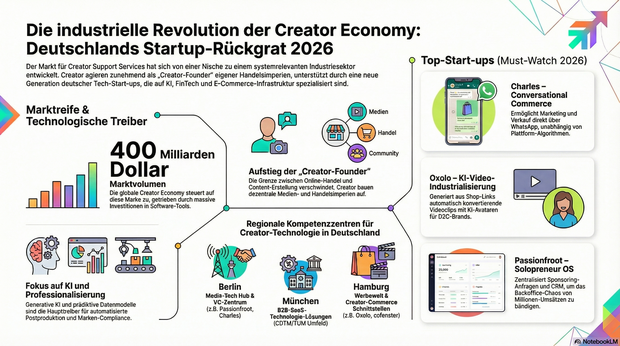

Start-up-Report: Creator Support Services

Die industrielle Revolution der Creator*innen ist in vollem Gange: Unser Report beleuchtet den boomenden Markt und zeigt die deutschen Tech-Start-ups, die das Rückgrat der neuen Medien-Champions bauen.

Wir erleben das Entstehen einer neuen ökonomischen Spezies: Der Creator-Founder. Die Grenze zwischen dem/der klassischen Online-Händler*in und dem/der modernen Content-Creator*in ist endgültig gefallen. Wer heute Reichweite besitzt, baut keine Community mehr auf, sondern ein dezentrales Medien- und Handelsimperium. Diese Transformation vom Nischenthema zur Systemrelevanz braucht jedoch eine industrielle Basis. Genau hier betritt eine neue Generation von Start-ups die Bühne. Diese „Werkzeugmacher*innen“ – spezialisiert auf KI-gesteuerte Produktion, autonome Analyse und FinTech – bilden das unsichtbare, hochprofitable Rückgrat einer Branche, die gerade ihre industrielle Revolution erlebt.

Das Ökosystem wird erwachsen

Die Marktlage im Jahr 2026 beweist eindrucksvoll, dass die Werkzeug-Infrastruktur für digitale Entrepreneur*innen den Kinderschuhen entwachsen ist. Laut aktuellen Hochrechnungen etablierter Investmentbanken steuert die globale Creator Economy unaufhaltsam auf die 400-Milliarden-Dollar-Marke zu, wobei ein signifikanter zweistelliger Prozentsatz direkt in Software- und Servicetools fließt.

Auch in Deutschland bestätigt der jüngste KfW-Gründungsmonitor diese Reife: Software-Lösungen für digitale Medienschaffende gehören zu den widerstandsfähigsten B2B-Segmenten der Post-Krisen-Ära. Der technologische Haupttreiber dieser rasanten Professionalisierung ist zweifellos die angewandte generative künstliche Intelligenz, dicht gefolgt von prädiktiven Datenmodellen. Deutsche Risikokapitalgeber*innen haben im vergangenen Jahr schätzungsweise über 350 Millionen Euro spezifisch in dieses Vertical gepumpt. Es geht längst nicht mehr um experimentelles Wagniskapital, sondern um Growth-Metriken und wiederkehrende SaaS-Umsätze in einem Markt, der eine beispiellose Professionalisierung erfährt.

Technologien der totalen Integration

Blickt man jenseits der offensichtlichen Dashboards, offenbaren sich die wahren Maschinenräume dieses Jahres. Drei Sub-Sektoren dominieren aktuell das Geschehen und treiben die Verschmelzung von Commerce und Content voran. Zunächst ist da die autonome KI-Postproduktion, bei der Algorithmen nicht nur schneiden, sondern selbständig Narrative für Verkaufsformate generieren.

Ein weiterer massiver Treiber ist die prädiktive Marken-Compliance. Hierbei handelt es sich um Legal-Tech-Lösungen, die vollautomatisiert Werbekennzeichnungspflichten und internationale Steuermodelle für Creator-Marken überwachen.

Schließlich etabliert sich das Creator FinTech, insbesondere durch umsatzbasierte Finanzierungsmodelle, die den dynamischen Cashflow von Influencer-Brands algorithmisch bewerten können. Während Pioniere der ersten Welle wie Linktree lediglich Brücken bauten, stoßen die aktuellen Akteure tief in diese hochkomplexen, technologischen Nischen vor, um den Creator*innen als vollwertigen E-Commerce-Akteur*innen zu befähigen.

Reality Check: Der Kater nach dem Hype

Dass diese Branche jedoch kein automatischer Garant für Einhörner ist, bewies der spektakuläre Crash der Web3-Creator-Plattformen um das Jahr 2023. Hochgelobte Projekte wie BitClout verbrannten Hunderte Millionen Dollar an Risikokapital, weil sie die Usability vernachlässigten und keinen echten Nutzwert jenseits der Spekulation boten. Aus diesem schmerzhaften Reality Check lassen sich vier fatale Fallstricke für heutige Gründer*innen ableiten. Der erste Fehler ist das API-Klumpenrisiko, also die blinde Abhängigkeit von den Launen großer Plattformen wie Meta oder YouTube. Ein zweites, oft tödliches Problem sind katastrophale Unit Economics bei Tools, die nur den nicht-monetarisierbaren "Long Tail" der Hobby-Nutzer*innen bedienen. Der dritte Fallstrick ist die chronische Unterschätzung der Regulatorik, insbesondere des EU AI Acts. Das vierte Learning betrifft den Technologie-Fetischismus: Wer Lösungen aufzwingt, die technologisch brillieren, aber in der alltäglichen User Experience der Creator*innen versagen, wird vom Markt gnadenlos abgestraft.

Deutschlands heimliche Creator-Hubs

Die architektonische Landkarte der deutschen Creator-Tool-Landschaft konzentriert sich 2026 auf hochspezialisierte Hotspots. Berlin bleibt der unangefochtene Magnet, angetrieben von einer dichten Konzentration an Media-Tech-VCs und der Strahlkraft von Kaderschmieden wie der ESMT. München agiert als das kraftvolle Gegenstück für harte Technologiebedingungen. Angefacht durch das CDTM und die TU München, entstehen hier vor allem datenlastige B2B-SaaS-Produkte für die Industrie. Das Rheinland, spezifisch die Achse Aachen und Köln, fungiert als historisch gewachsenes Cluster, das auf dem Fundament klassischer TV-Produktionen und starken Informatik-Fakultäten wie der RWTH Aachen basiert. Abgerundet wird dieses Netzwerk durch Hamburg. Die Hansestadt nutzt ihre tiefe Verwurzelung in der Werbe- und Agenturwelt sowie Netzwerke wie den Next Media Accelerator, um Tools zu entwickeln, die genau an der Schnittstelle zwischen Markenbudgets und der Creator-Commerce-Welt ansetzen.

Investor*innen-Radar

Ein genauer Blick auf die Geldgeber*innen offenbart, wer das Benzin für diese Maschine liefert. Bei den spezialisierten VCs haben Akteure wie Creator Ventures den Takt vorgegeben, während in Deutschland vor allem Vehikel rund um OMR Ventures den tiefen Brancheneinblick für Seed-Finanzierungen nutzen. Auf der Ebene der Top-Tier Generalisten sehen wir Fonds wie Creandum, Cherry Ventures und Point Nine, die ihre rigorosen B2B-SaaS-Metriken nun konsequent auf Creator-Tools anwenden. Die Industrie mischt über Corporate VCs ebenfalls kräftig mit; hier sichern sich Bertelsmann Investments oder SevenVentures strategische Marktanteile, um ihre eigenen Wertschöpfungsketten zu digitalisieren. Der eigentliche Motor der Frühphase sind jedoch die Business Angels und Syndikate. Hier agieren Digitalgrößen wie Philipp Westermeyer oder Prominente wie Mario Götze als strategische Türöffner, die den Start-ups unmittelbaren Zugang zu jener Creator-Elite verschaffen, die heute die Märkte bewegt.

Die Top Start-ups (Must-Watch 2026)

Die für diesen Report ausgewählten Start-ups wurden anhand einer rigorosen Analyse ihrer Marktrelevanz im Jahr 2026, ihres technologischen Reifegrades sowie der Stabilität ihrer Geschäftsmodelle bewertet. Ein wesentliches Kriterium war zudem das Investoren-Vertrauen durch namhafte Risikokapitalgeber. Wir betrachten ausschließlich Unternehmen mit Hauptsitz in Deutschland, die ab dem Jahr 2020 gegründet wurden, um den aktuellen Innovationszyklus der "Post-Plattform-Ära" präzise abzubilden – jene Ära, in der Creator zu echten Handelsmarken werden.

Passionfroot (Gegründet 2021)

Das Team um Jennifer Phan, Jens Willemen und Michelle Tian hat von Berlin aus einen globalen Standard gesetzt. Ihr B2B-SaaS-Modell bietet einen ganzheitlichen Workspace, der Sponsoring-Anfragen und CRM für Creator zentralisiert. Der USP ist die radikale Vereinfachung des Backoffice-Chaos für jene „Solopreneur*innen“, die heute Millionenumsätze verwalten. Namhafte VCs wie Creandum und Cherry Ventures investierten hier in einer Seed-Runde 3 Millionen Euro in Passionfroot.

Nindo (Gegründet 2020)

Gegründet von Rezo und Tim Jacken in Aachen, ist Nindo der Inbegriff für den Sprung von Content-Expertise zu tiefen B2B-Data-SaaS-Lösungen. Das Unternehmen bietet granularste Analytics und Reichweiten-Validierungen für das Influencer-Marketing. Durch den Einstieg und die strategische Partnerschaft mit dem globalen Medienhaus Webedia stützt Nindo heute maßgeblich das Wachstum jener Marken, die auf datenbasierte und verifizierte Creator-Kooperationen setzen.

cofenster (Gegründet 2020)

Die Hamburger Gründer Tom Vollmer, Oliver Wegner und Finn Frotscher adressieren die „Corporate Creator Economy“. Ihr Tool ermöglicht es Unternehmen, Mitarbeiter-Content via KI-Guidance in professionelle Verkaufs- und Info-Videos zu verwandeln. Dieser Ansatz sicherte cofenster unter anderem eine Seed-Finanzierung in Höhe von 1,5 Millionen Euro, angeführt von Capnamic Ventures.

Charles (Gegründet 2020)

Artjem Weissbeck und Andreas Tussing bringen mit Charles Conversational Commerce nach Berlin. Ihr SaaS-Modell erlaubt es E-Commerce- und Creator-Brands, Marketing und Verkauf vollständig über WhatsApp abzuwickeln. Der USP liegt in der direkten Monetarisierung ohne Algorithmus-Abhängigkeit, was Salesforce Ventures im Rahmen einer Series-A-Runde zu einem Investment von 20 Millionen Dollar veranlasste.

Wonnda (Gegründet 2022)

Das Berliner Duo Martin Ditzel und Oliver Allmoslechner schließt die Lücke zwischen digitaler Reichweite und physischem Handel. Als B2B-Marktplatz verbindet Wonnda Creator*innen mit europäischen Hersteller*innen für Eigenmarken. Die Plattform digitalisiert das Sourcing und zementiert den Trend zum „Creator-as-a-Manufacturer“, finanziert von namhaften Frühphasen-VCs wie Pitchdrive.

Oxolo (Gegründet 2020)

Das Hamburger Team um Elisabeth L’Orange und Heiko Hubertz besetzt die entscheidende Schnittstelle, an der 2026 die Grenze zwischen klassischem E-Commerce und Creator-Content endgültig verschwindet. Ihr „URL-to-Video“-Modell generiert aus schlichten Shop-Links hochgradig konvertierende Videoclips mit KI-Avataren. Dass Oxolo primär von „Sellern“ spricht, ist ein strategisches Understatement: In Wahrheit nutzen vor allem Creator-Founders das Tool, um ihre D2C-Brands zu industrialisieren. Mit einer Series-A-Finanzierung von 13 Millionen Euro (Lead: DN Capital) ist Oxolo der unsichtbare Motor hinter dem kommerziellen Erfolg moderner Creator-Marken.

Moojo (Gegründet 2021)

Das Berliner Start-up von Amir Djouadi, Christian Engnath und Utena Treves fungiert als das finanzielle Rückgrat der dezentralen Wirtschaft. Moojo bietet eine integrierte FinTech-Lösung, die Rechnungsstellung und sofortige Auszahlungen für Creator*innen automatisiert. Durch die Reduzierung von Zahlungsverzögerungen löst das Start-up eines der größten Liquiditätsprobleme der Branche, unterstützt durch ein 2-Millionen-Dollar-Pre-Seed-Funding von b2venture und APX.

ZebraCat (Gegründet 2022)

Reza Zolfaghari und Michael Baumgartner konzentrieren sich mit ZebraCat in Berlin auf die „Prompt-to-Video“-Revolution. Ihr Modell ermöglicht es Creator*innen, durch einfache Textbeschreibungen komplexe Video-Narrative inklusive Schnitt zu generieren. Als Absolventen von Entrepreneur First verkörpern sie die neue Generation von KI-Tools, die den kreativen Prozess radikal beschleunigen.

Internationaler Ausblick & Fazit

Der Blick auf die globale Makroebene zeigt, dass die europäische Creator Economy erst am Anfang einer tiefgreifenden Umwälzung steht. Aus Asien schwappt die nächste Evolutionsstufe der Live-Commerce-Infrastruktur herüber, während in den USA autonome KI-Agenten bereits die Verhandlungen komplexer Marken-Deals übernehmen. Für den europäischen Markt bedeutet dies: Wer heute noch isolierte Content-Tools baut, wird den Anschluss an den Handel verlieren. Die Zukunft gehört jenen Plattformen, die den gesamten Workflow vom ersten Frame bis zum finalen Checkout digitalisieren.

Das Fazit für Gründer*innen und Investor*innen: Die Creator Economy ist kein flüchtiger Trend mehr, sondern das Betriebssystem des modernen Mittelstands. Wer die Souveränität über die eigene Technologie und die eigenen Daten besitzt, wird die Medienhäuser und Handelskonzerne von morgen führen.

NBH-Systems: Zwischen Schaltschrank und Skalierbarkeit

Wie Dorian Tobollik und Timo Hartig mit ihrem Hardware-Start-up NBH-Systems eine Industrie-Nische knacken wollen.

Laptops, die prekär auf Maschinengehäusen balancieren, oder kniende Instandhalter*innen, die notgedrungen mit einer Hand tippen – der Arbeitsplatz im technischen Service ist selten ergonomisch. Aus genau diesem alltäglichen „Pain Point“ heraus ist das Start-up NBH-Systems entstanden. Wie Dorian Tobollik und Timo Hartig mit ihrem Hardware-Unternehmen eine Industrie-Nische knacken wollen, haben wir analytisch unter die Lupe genommen.

Vom Pain Point zum Produkt

Die Entstehungsgeschichte des hessischen Start-ups ist ein klassisches Lehrstück für anwendergetriebene Innovation. Dorian Tobollik, selbst langjähriger Systemtechniker, erlebte das Fehlen eines stabilen Arbeitsplatzes an Maschinen und Anlagen immer wieder als echten Effizienz- und Sicherheitskiller. Anstatt den Status quo hinzunehmen, ging er ans Reißbrett und entwickelte eigene Prototypen.

Doch der Weg zur Serienfertigung „Made in Germany“ barg Tücken. „Der Weg vom ersten Prototyp bis zur Serienfertigung war deutlich aufwendiger, als ich am Anfang gedacht habe“, räumt Tobollik rückblickend ein. Der große Vorteil lag jedoch in seiner eigenen Berufspraxis: „Die Idee kam direkt aus meinem Arbeitsalltag als Servicetechniker. Ich habe das Produkt selbst täglich im Einsatz gehabt, konnte es direkt testen und immer wieder anpassen.“