Aktuelle Events

Sproutling: Matratzen gegen Erstickungsgefahr für Babys

Wenn sich Babys beim Schlafen auf den Bauch drehen, kann das im schlimmsten Fall zu Sauerstoffmangel und Erstickung führen. Sproutling möchte hier mit seiner Matratze für mehr Sicherheit sorgen.

Meltem Aktürk möchte mit Sproutling "die Sicherheit beim Babyschlaf revolutionieren". Die Idee zu der Kindermatratzenmarke entstand der ehemaligen Investmentbankerin einst im Gespräch mit ihrer Freundin.

Sproutling als Alternative zur normalen Matratzen

Die frischgebackene Mama machte sich darüber Sorgen, dass ihr Baby sich nachts auf den Bauch dreht und dabei mit Mund und Nase auf der Matratze liegt. Aus Angst vor dieser für Kleinkinder gefährlichen Schlafposition konnte sie nachts nicht schlafen. "Tatsächlich sterben erschreckenderweise immer wieder Babys im Schlaf", wusste Aktürk und fing an zu recherchieren. "Herkömmliche Matratzen bestehen oft aus einem Kern aus Schaumstoff, eingehüllt in einen dicken Textilbezug und manchmal noch mit einem Nässeschutz aus Plastik bezogen – alles andere als luftdurchlässig."

Mithilfe von Hebammen hat die Gründerin folglich ein Jahr lang geforscht und entwickelt. Das Ergebnis: Sproutling – eine atmungsaktive Babymatratze.

Sie ist, der Gründerin nach, vollständig luftdurchlässig und gibt dem Baby dadurch mehr Sicherheit im Schlaf. Der Kern besteht aus einer Vielzahl an Polymer-Fäden. Zusammengepresst würden deswegen viele Hohlräume entstehen, sodass Luft frei durch die gesamte Matratze strömen könne. Trotzdem sei sie fest genug, um ein Einsinken des Kindes zu verhindern.

Der vollständig abnehmbare sproutling-Bezug besteht an der Oberfläche aus Lyocell, einer industriell hergestellten Faser aus dem Holz der Eukalyptuspflanze: "In ihm eingearbeitet ist ein Abstandsgewirke, sodass im Bezug selbst eine Luftschicht entsteht. Und nur in dieser Kombination von Kern und Bezug erreichen wir maximalen Komfort bei maximaler Luftdurchlässigkeit", erklärt Aktürk.

Die Matratzen gibt es in zwei Größen, Kern und Bezug sind waschbar und ergänzend dazu werden atmungsaktive Spannbettlaken aus Musselin angeboten.

Mehr dazu am Montag, 20.05.23, in der Höhle der Löwen. Zudem dabei: Zebra Ice, kruut, hiddencontact und Bildungsurlauber.de

Diese Artikel könnten Sie auch interessieren:

Investforum Pitch-Day 2026 bringt Startups und Innovationen nach Dessau

Am 16. September 2026 findet im Technikmuseum Hugo Junkers in Dessau der nächste Investforum Pitch-Day statt. Das etablierte Startup- und Matching-Event zählt zu den wichtigsten Formaten für Frühphasen-, Gründungs- und Wachstumsfinanzierung in Sachsen-Anhalt und bringt seit mittlerweile 17 Jahren innovative Startups, Investoren, Unternehmen und Netzwerkpartner aus ganz Deutschland zusammen.

Gesucht werden branchenübergreifend Teams mit skalierbaren Geschäftsmodellen, innovativen Technologien und Wachstumspotenzial – unter anderem aus den Bereichen KI & Software, Bio & Life Science, Clean Tech, FinTech, Food, Consumer Products oder E-Commerce. Auch Forschungsprojekte mit verwertbaren Ergebnissen und konkretem Anwendungspotenzial können sich bewerben.

Im Mittelpunkt stehen kompakte Pitch-Sessions, kuratierte 1:1-Matchings mit Investoren und direkter Austausch mit Branchenakteuren. Zusätzlich profitieren die ausgewählten Teams von einer professionellen Vorbereitung durch Workshops, Pitchtrainings sowie Unterstützung bei Pitch- und Read Decks.

Darüber hinaus bietet der Investforum Pitch-Day Networking mit Business Angels, VCs und Unternehmen sowie Keynotes rund um Innovation und Wachstum. Ein weiterer Höhepunkt ist die Verleihung des Awards „Überzeugendstes Startup“ der Stadtwerke Halle GmbH, dotiert mit 2.500 Euro, sowie des „TK-Sonderpreis Gesundheit“ der Techniker Krankenkasse Sachsen-Anhalt, dotiert mit 1.000 Euro.

Mit der HANGAR Night erwartet die Teilnehmenden außerdem ein besonderes Abendformat mit Innovation Walks, Drinks, Live-Musik und Austausch in außergewöhnlicher Atmosphäre.

Die Bewerbungsphase läuft noch bis zum 14. Juni 2026. Weitere Informationen zu Teilnahmebedingungen, Förderung und Bewerbung gibt es unter: pitchday.investforum.de

Der Investforum Pitch-Day 2026 ist ein Angebot der IMPETUUM GmbH – Institut für Wissens- und Technologietransfer an der Martin-Luther-Universität Halle-Wittenberg – und wird durch das Ministerium für Wirtschaft, Tourismus, Landwirtschaft und Forsten mit Mitteln des Europäischen Sozialfonds Plus und des Landes Sachsen-Anhalt gefördert

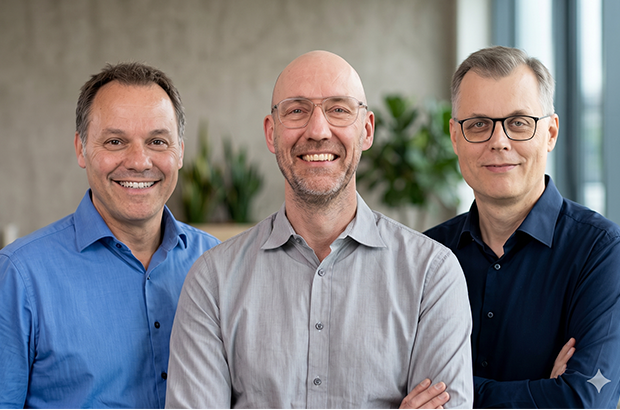

Gewohnheit statt Willenskraft: Kann das Düsseldorfer Start-up BlueHabits den Fitness-Markt umprogrammieren?

80 Prozent aller guten Vorsätze scheitern. Das HealthTech-Start-up BlueHabits will dieses Problem mit einer Mischung aus künstlicher Intelligenz und kognitiver Neurowissenschaft lösen. Pünktlich zur FIBO im April 2026 brachte das Team um Dr. Eike Buabang, Arnd Jäger, Markus Meißner und Marco Oevermann seine App und eine B2B-Plattform auf den Markt. Kann das, was die Gründer als „Habit Blueprint“ bezeichnen, im extrem umkämpften Fitness-Markt wirklich bestehen? Unser Blick auf das Düsseldorfer Start-up.

BlueHabits ist ein noch junges Unternehmen in der deutschen Start-up-Szene. Erst im Spätsommer 2025 wurde das Unternehmen mit Sitz in Düsseldorf offiziell ins Handelsregister eingetragen. Dennoch legt das Unternehmen ein beachtliches Tempo vor, was vor allem an der Erfahrung des Gründerteams liegt, das eine interessante Brücke zwischen Wissenschaft und kommerzieller Skalierung schlägt. Auf der wissenschaftlichen Seite steht Dr. Eike Buabang, kognitiver Neurowissenschaftler am renommierten Trinity College in Dublin. Seine Forschung fokussiert sich auf die neuronalen Mechanismen von Gewohnheiten.

Den unternehmerischen Gegenpol bildet Arnd Jäger, der als Serial Entrepreneur bereits Erfahrung im digitalen Gesundheitsmarkt gesammelt hat – unter anderem als Gründer und CEO der Online-Gruppen-Psychotherapie-Plattform webPRAX. Komplettiert wird das Führungsteam durch die Mitgründer Markus Meißner und Marco Oevermann, die technologische und operative Expertise in die Waagschale werfen. Der Launch der Lösung wurde flankiert von der Auszeichnung als „Young Innovator“ durch das Bundeswirtschaftsministerium auf der vergangenen Fitnessmesse FIBO 2026.

Doch wie findet ein Neurowissenschaftler aus Dublin überhaupt mit einem Serial Entrepreneur aus Deutschland zusammen? „Arnd hat nach einem renommierten Gewohnheitsforscher aus der EU unter 35 gegoogelt – und ich stand wohl ganz oben im Ranking“, erinnert sich Dr. Eike Buabang schmunzelnd. Nach einer ersten E-Mail und einem einstündigen Call auf Englisch fiel schließlich der Groschen: Beide stammen aus dem Rheinland. „Wir hätten eigentlich auch gleich Deutsch sprechen können“, lacht der Forscher. „Der Rest ist Geschichte.“

Dieses pragmatische Tempo spiegelt sich auch in der Finanzierung wider. Das Team wählte einen unkonventionellen Weg und verzichtete beim Seed-Investment komplett auf institutionelle Geldgeber. „Wir halten wenig davon, nur im Konjunktiv zu sprechen“, betont Buabang. „Wir wollen gleich am Anfang zeigen, dass unser Modell funktioniert.“ Die erste offizielle VC-Runde wolle man erst starten, wenn der erste große B2B-Kunde an Bord sei.

Produkt & Geschäftsmodell: Ein zweigleisiger Ansatz

Im Kern entwickelt BlueHabits einen KI-Begleiter, der Nutzer*innen hilft, neue Routinen im Alltag zu verankern. Statt auf Motivation und reine Willenskraft – die laut Buabang chronisch fehleranfällig sind – setzt die App auf einen individuellen „Habit Blueprint“. Die KI erkennt Hürden frühzeitig und passt die Routinen dynamisch an. Es geht nicht um den reinen Trainingsplan an sich, sondern um das System davor und danach: Wie kommt man überhaupt ins Gym und wie bleibt man langfristig am Ball?

Wie das jenseits der üblichen Branchen-Buzzwords funktioniert, erklärt Mitgründer Markus Meißner: „Wir arbeiten unter anderem mit GPS, um orts- und zeitabhängig intervenieren zu können.“ Statt auf Standard-Push-Nachrichten setze das System auf tief personalisierte Trigger. Meißner veranschaulicht das am klassischen Feierabend-Tief: Droht die Couch nach einem langen Arbeitstag zu gewinnen, kreiert die KI eine kurze, maßgeschneiderte Meditation. „Diese wird mit Musik unterlegt, die Hormone wie Dopamin, Oxytocin und Endorphine freisetzt. So erzeugen wir positive Emotionen, die helfen, dem Sofa Lebewohl zu sagen“, verspricht der Tech-Experte. Unabhängige klinische Studien, die diese gezielte hormonelle Wirkung der App-Musik belegen, liegen der Redaktion jedoch nicht vor.

Kämpft ein(e) Nutzer*in hingegen mit dem Zeitmanagement oder Rückschlägen, schlüpft die KI in die Rolle eines individuellen Mentors. Den wahren USP sieht das Team jedoch in der Perspektive auf das Problem. „Das Neue an unserer Idee ist, dass wir uns gar nicht so sehr mit der Ausführung der eigentlichen Gewohnheit auseinandersetzen, sondern das Drumherum im Fokus haben“, fasst Meißner zusammen – unabhängig davon, ob es um das Gym, die Ernährung oder gar ein Change-Management-Projekt in einem Großunternehmen geht.

Während die im April 2026 in den App Stores gestartete Anwendung das B2C-Schaufenster des Start-ups ist, liegt der wahre wirtschaftliche Hebel im B2B-Modell. BlueHabits bietet eine technologische Plattform an, die sich als White-Label- oder Integrationslösung in bestehende digitale Angebote von Fitnessketten, Krankenversicherungen oder dem Betrieblichen Gesundheitsmanagement (BGM) einbetten lässt.

Monetarisierung & Fitnessstudio-Paradoxon

So vielversprechend der wissenschaftliche Ansatz klingt, so kritisch muss die Monetarisierung betrachtet werden, insbesondere im Hinblick auf das klassische Fitnessstudio-Paradoxon. Es ist ein offenes Geheimnis der Branche, dass Betreiber*innen wirtschaftlich stark von sogenannten Karteileichen profitieren. Warum sollte ein Studio für eine Software zahlen, die genau diese lukrative Zielgruppe mobilisiert und damit die Auslastung sowie den Verschleiß der Geräte signifikant erhöht?

Arnd Jäger kontert diesen Vorbehalt mit einer klaren wirtschaftlichen Differenzierung: „Bei einem Beitrag von 15 Euro kündigen weniger Mitglieder als bei einem Beitrag von 80 Euro im Monat. Wir wissen, dass bei hochpreisigen Studios mehr als 30 Prozent der Neumitglieder in den ersten drei Monaten wieder kündigen. Da kommt einiges zusammen.“

Dass eine bessere Retention (Kund*innenbindung) lukrativer ist als eine hohe Fluktuation, untermauert das Start-up derzeit akademisch. Nach eigenen, von der Redaktion bisher nicht verifizierten Angaben, führen die Gründer derzeit eine groß angelegte „Real-World-Evidence“-Studie mit der Uniklinik Eppendorf, der Oxford University und der McGill Universität durch, um belastbare Daten zur nachhaltigen Verhaltensänderung zu sammeln. Den deutlich größeren Hebel sieht Jäger ohnehin außerhalb der klassischen Muckibuden: in der Integration der Plattform in bestehende Online-Größen wie Peloton, Zwift oder Les Mills. „Da verfolgen wir konsequent den integrativen Stripe-Ansatz nach dem Baukasten-Prinzip“, erläutert der CEO. „Eine zusätzliche Applikation als Stand-alone-Lösung neben der eigentlichen Fitness-Anwendung will doch keiner mehr nutzen.“

Ein weiterer potenzieller Absatzkanal ist der Markt für das BGM. Dieser Sektor ist zwar finanziell äußerst lukrativ, aber gleichzeitig berüchtigt für hochkomplexe Entscheidungsprozesse. Zudem kommt hier die sensible Frage des Datenschutzes ins Spiel: Arbeitgeber und Versicherungen sind beim Thema Gesundheitsdaten extrem vorsichtig.

Auf die kritische Frage, wie BlueHabits bei intimsten Verhaltensdaten die Hoheit der Nutzerinnen garantieren will, beteuert Mitgründer Marco Oevermann eine strikte Trennung: „Wir behandeln Verhaltensdaten strikt als persönliche Daten der Nutzerinnen, nicht als B2B-Datenbestand. Arbeitgeber oder Versicherer erhalten keinerlei Zugriff.“ Auf konkrete Nachfrage zur genauen algorithmischen Datenverarbeitung bleibt Oevermann jedoch vage und versichert lediglich auf Management-Ebene die Einhaltung hoher Sicherheitsstandards: „Für unsere KI gilt: nur notwendiger Kontext, keine direkten Identifikatoren und keine automatisierten Entscheidungen.“ Man nehme das Thema durch Vorerfahrungen im Bereich zertifizierter Videosprechstunden aus tiefster Überzeugung ernst.

Markt & Wettbewerb: Schwimmen im Red Ocean

Der Markt für digitale Habit-Tracker ist gnadenlos übersättigt. Im Endkundensegment tritt BlueHabits gegen etablierte Player wie Habitify, Streaks oder die App Fabulous an, während US-Giganten wie Noom die Standards setzen. Die B2C-Kund*innengewinnung dürfte angesichts dieser Konkurrenz eine Herkulesaufgabe werden.

Angesprochen auf diesen Kampf gegen Goliath, winkt Arnd Jäger jedoch gelassen ab. „Der B2C-Markt war hinsichtlich unseres Geschäftsmodells für uns nie interessant“, stellt der Serial Entrepreneur klar. Dass die App nun überhaupt für Privatpersonen kostenfrei in den Stores landet, diene einem anderen Zweck: „Wir haben sie lediglich dorthin gebracht, um unseren Proof of Concept zu erreichen und unsere Methode ohne Umwege direkt am Markt zu verbessern“, räumt Jäger ein.

Fazit

Trotz des rauen Umfelds wählt BlueHabits strategisch einen klugen Weg. Anstatt sich nur im teuren App-Store-Kampf aufzureiben, positioniert sich das Team als Infrastruktur-Anbieter für den Gesundheitsmarkt. Die Kombination aus tiefer neurowissenschaftlicher Evidenz und handfester Start-up-Erfahrung ist das stärkste Asset der Düsseldorfer. Der finale Erfolg wird jedoch allein von der Vertriebsexekution im Geschäftskund*innenbereich abhängen. Gelingt es den Gründern, große Ketten oder Krankenkassen davon zu überzeugen, dass der „Habit Blueprint“ den Customer Lifetime Value erhöht, hofft das Team, BlueHabits als Hidden Champion der Branche zu positionieren.

Mit der FIBO 2026 ist ein wichtiges Etappenziel erreicht, doch die eigentliche Arbeit beginnt erst jetzt. „Es ist nun essenziell, unsere ersten Kunden zufriedenzustellen und ein kontextunabhängiges SDK (Software Development Kit) für den B2B-Markt zur Verfügung zu stellen“, skizziert Markus Meißner die harte Roadmap für die kommenden zwölf Monate. Auch beim Thema Risikokapital bleibt das Team vorerst unaufgeregt: „Die erste große Finanzierungsrunde werden wir erst starten, wenn unsere Studie unter Dach und Fach ist und unser System bei unseren ersten Kunden erfolgreich läuft.“

paXos Solar: Das Kraftwerk-Dach

Sieben Jahre Entwicklung, ein renommierter Design-Preis und ein ambitioniertes Crowdinvesting: Wie das Start-up paXos Solar der Gründer Karsten Birkholz und Guido Schumacher den umkämpften Markt für gebäudeintegrierte Photovoltaik (BIPV) aufmischen will – und warum das Nadelöhr im Handwerk liegt.

Das Langenfelder GreenTech-Start-up paXos Solar hat mit seinem „Multi-Energie-Dach“ den Green Product Award 2026 in der Kategorie Building Design gewonnen. Das Konzept verspricht, das Dach vom bloßen Witterungsschutz zum integrierten Kraftwerk für Strom und Wärme zu transformieren. Für das Hardware-Start-up markiert dieser renommierte Preis einen Meilenstein auf dem Weg zur nächsten Finanzierungsrunde. Dennoch zeigt ein tieferer Blick auf das Geschäftsmodell, die tiefen Wurzeln des Teams im Engineering und die hochkomplexe Wettbewerbslandschaft, dass der Markt für gebäudeintegrierte Photovoltaik (BIPV) weit mehr verlangt als gutes Design.

Die Auszeichnung als Momentum

Ende Mai 2026 wurde im Berliner Colosseum der Green Product Award verliehen. Unter 1.200 Einreichungen aus 54 Ländern setzte sich das Multi-Energie-Dach von paXos durch. Die Jury lobte insbesondere den ganzheitlichen Ansatz, der Aspekte wie Verarbeitung, Lebenszyklus, Langlebigkeit und die Kreislauffähigkeit der Materialien berücksichtigt. Für paXos kommt die Auszeichnung genau zur rechten Zeit, da das Start-up in rund einem Monat eine Skalierungsrunde über die Crowdinvesting-Plattform FunderNation starten will.

Warum man sich in einer solch kapitalintensiven Hardware-Phase für die Crowd und gegen klassisches Venture Capital (VC) entschieden hat? „Wir sehen Crowdinvesting nicht als Ersatz für professionelle Investoren, sondern als sehr passenden Baustein für unsere aktuelle Skalierungsphase“, erklärt CFO Guido Schumacher. Über die Plattform könne man Kapital aufnehmen, ohne die Gesellschafterstruktur zu früh und zu stark zu verwässern.

Zudem gehe es um Reichweite und Community-Aufbau. Schumacher betont: „Unser Produkt lebt von Vertrauen, Sichtbarkeit und Weiterempfehlung. Eine Crowdinvesting-Kampagne bringt uns mit Menschen zusammen, die die Energiewende im Gebäudesektor aktiv unterstützen, selbst bauen oder im Handwerk tätig sind.“

„Klassisches VC-Geld schließen wir für spätere, größere Skalierungsschritte nicht aus“, räumt er ein. Doch zunächst liege der Fokus auf dem aktuellen Ausbau. „Für den nächsten Marktausbau planen wir ein Finanzierungsziel von bis zu 1,5 Millionen Euro“, kündigt der CFO an. „Damit wollen wir insbesondere Material und Projekte vorfinanzieren sowie unser Vertriebs- und Verarbeitungspartnernetzwerk ausbauen.“

Die Wurzeln im Engineering: Ein Corporate Spin-off mit langem Atem

Hinter paXos Solar steckt kein klassisches Hochschul-Spin-off in den frühen Zwanzigern. Das Kernteam um CEO Karsten Birkholz und CFO Guido Schumacher verbindet eine über 30-jährige gemeinsame berufliche Vorgeschichte, stark verwurzelt in der Automobilindustrie und dem klassischen Engineering. Zusammen mit Erfinder Peter Hakenberg bauten sie ab 2015 zunächst das erfolgreiche Ingenieurbüro paXos Consulting & Engineering auf.

Bereits im Jahr 2017 sorgte die Truppe auf der Hannover Messe für Schlagzeilen, als erste Prototypen in den Medien voreilig als deutsche Antwort auf das Tesla Solar Roof gehandelt wurden. Guido Schumacher relativiert diesen frühen Hype heute: „Der Tesla-Vergleich war damals natürlich aufmerksamkeitsstark, aber 2017 standen wir nicht kurz vor einem fertigen Marktstart.“

Bis das hardwareintensive Produkt vollends marktreif war, vergingen fast sieben Jahre. Erst Ende 2024 startete das Unternehmen voll in den operativen Betrieb. „Ein Solardach ist kein klassisches Tech-Produkt, das man nach einem funktionierenden Demonstrator einfach skaliert“, gibt Schumacher zu bedenken. „Es muss über Jahrzehnte dicht, sicher, belastbar und wirtschaftlich funktionieren – und es muss auf der Baustelle von Dachdeckern verarbeitet werden können.“

Dass paXos diese enorm lange und risikoreiche Vorlaufzeit überstand, lag auch an der eigenen Entstehungsgeschichte. „Ein wesentlicher Teil der frühen Entwicklung konnte über paXos Consulting & Engineering querfinanziert werden“, verrät der CFO. Die wahre Hürde sei eine andere gewesen: „Die größte Herausforderung lag weniger in der Technik als im mentalen Wechsel“, blickt er zurück. „Als Ingenieurdienstleister denkt man in individuellen Kundenprojekten. Als Produktunternehmen muss man in Standards, Wiederholbarkeit, Lieferketten und Marge denken.“

Technologie und Lieferkette: Das Doppelkraftwerk auf dem Prüfstand

Das Kernprodukt von paXos ersetzt konventionelle Dachziegel vollständig. Auf einem soliden Unterdach aus gewöhnlichem Stahltrapezblech werden werkzeuglos Solarmodule eingehängt. Der technologische Clou: Ein Kamineffekt zwischen Blech und Modul sorgt für eine kontinuierliche Hinterlüftung, was einen leistungsmindernden Hitzestau verhindert. Die warme Luft wird zudem abgesaugt und einer Wärmepumpe zugeführt, was deren Energiebedarf laut Unternehmensangaben um bis zu 20 Prozent senken kann.

Auf die kritische Frage nach der Resilienz der globalen Lieferketten antwortet CEO Karsten Birkholz entwaffnend ehrlich: „Unsere Glas-Glas-Solarmodule werden aktuell in Asien nach unseren Spezifikationen gefertigt.“ Er verteidigt diesen Schritt selbstbewusst: „Dort finden wir derzeit die beste Kombination aus hoher Fertigungsqualität, technologisch führender Zelltechnologie und wirtschaftlicher Skalierbarkeit.“

Dennoch versichert Birkholz, sich nicht von Standard-Importen abhängig zu machen. „Wir kaufen keine Standardmodule von der Stange. Die paXos-Qualität entsteht durch unser spezifisches Moduldesign und die Integration in unser Dachsystem“, betont der CEO. Die eigentliche Wertschöpfung des Start-ups liege in der Systemintegration und der Logik des Dachaufbaus.

Der Markt und seine kritischen Hürden

Obwohl der Markt für energetische Dachsanierungen gigantisch ist, muss sich paXos in einem dicht besiedelten Umfeld gegen Anbieter wie Autarq, Ennogie oder traditionelle Ziegelhersteller behaupten. Die größte Skalierungshürde liegt jedoch oft nicht in der Technologie, sondern in der Schnittstelle zum traditionellen Handwerk. Ein Indach-System verwischt häufig die Grenzen zwischen dem/der Dachdecker*in und dem/der Elektriker*in – was in der Praxis regelmäßig zu Gewährleistungsängsten führt.

PaXos begegnet diesem Flaschenhals mit einer strikten konzeptionellen Trennung. „Unser wichtigstes Argument ist: Es bleibt im Kern ein Dachsystem“, stellt Karsten Birkholz klar. „Wir trennen die Funktionen bewusst: Das Unterdach übernimmt die Wasserführung und den Wetterschutz, die PV-Ziegel bilden die energieerzeugende Ebene darüber.“ Das reduziere die Sorgen der Handwerker*innen massiv.

Zudem punkte man mit hoher Reparaturfreundlichkeit, verspricht der CEO: „Bei uns können einzelne Module vergleichsweise einfach ausgetauscht werden, ohne das gesamte Dach öffnen zu müssen. Das ist für Dachdecker ein starkes Argument, weil es die langfristige Verantwortung beherrschbarer macht.“ Sein Fazit zum Schnittstellen-Problem ist entsprechend deutlich: „Wir verwischen die Gewerke nicht, sondern strukturieren sie sauber. Der Dachdecker verantwortet den Dachaufbau und die Montage, der Elektriker verantwortet Verschaltung und Inbetriebnahme.“

Einordnung für die StartingUp-Community

Für Gründer*innen und Investor*innen im GreenTech-Sektor liefert paXos Solar eine wertvolle Fallstudie. Der Case untermauert, dass physische Hardware im CleanTech-Bereich zwar langwierig ist, aber das unverzichtbare Rückgrat der realen Energiewende bildet.

Darüber hinaus bedient die intelligente Verschmelzung der klassischen Gebäudehülle mit moderner Stromerzeugung und thermischer Unterstützung exakt das ganzheitliche Denken, das heute von modernen ESG-Investor*innen gefordert wird. Der anstehende Schritt hin zum Crowdinvesting ist dabei ein strategisch kluger Schachzug, um bei einem emotional aufladbaren Produkt Kleininvestor*innen direkt zu Markenbotschafter*innen zu machen. Ob das erfahrene Team nach den Design-Jurys nun auch das traditionelle deutsche Bauhandwerk in der Breite überzeugen kann, wird sich in der anstehenden Wachstumsphase zeigen müssen.

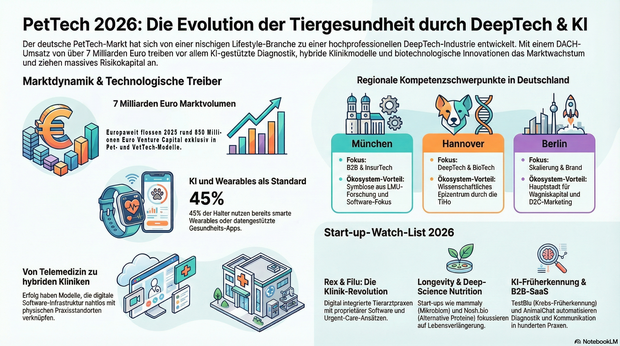

SportTech-Start-up-Report 2026

Der Hype ist tot, die KI übernimmt: Wie DeepTech den SportTech-Markt 2026 dominiert – und welche deutschen Start-ups das Milliarden-Rennen machen.

Der Geruch von Rasen weicht zunehmend dem leisen Surren von Hochleistungsservern. Wer im Jahr 2026 an die Sportindustrie denkt, darf nicht mehr nur an überfüllte Stadien und verschwitzte Trikots denken, sondern muss Algorithmen, Drohnen und neuronale Netze vor Augen haben. Die Transformation der SportTech- und E-Sports-Branche hat endgültig den Sprung vom verspielten Nischenthema zum essenziellen Wirtschaftsfaktor geschafft – doch der Weg dorthin war ein brutaler Ausleseprozess. Wo vor wenigen Jahren noch blind Millionen in naive Krypto-Träume, überteuerte Fitness-Gadgets und kurzlebige Influencer-Ligen gepumpt wurden, ist nach einer beispiellosen Welle spektakulärer Start-up-Pleiten nun knallharter Realismus eingekehrt.

Der Markt hat sich radikal bereinigt: Heute werten hochkomplexe, KI-basierte digitale Coaches die Biomechanik von Athlet*innen in Echtzeit aus. Physischer Spitzensport und digitale Welten verschmelzen in hybriden Ligen, während Augmented Reality das Fan-Erlebnis im heimischen Wohnzimmer neu definiert. Es ist ein Milliardenmarkt entstanden, der klassische Vereinsstrukturen aufbricht und Gründer*innen eine erbarmungslose Arena bietet: Der Hype ist tot, es überleben nur noch Start-ups mit echter technologischer Substanz.

Die Marktlage: Milliarden-Wetten auf die digitale Athletik

Der Markt für Sporttechnologie und E-Sports hat seine post-pandemische Findungsphase längst hinter sich gelassen und präsentiert sich so reif und kapitalstark wie nie zuvor. Ein Blick auf die realen Marktdynamiken genügt: Branchenspezifische Analysen internationaler Tech-M&A-Berater*innen belegen das kontinuierliche Wachstum des globalen SportsTech-Marktes. Parallel dazu zeigen die fundierten Erhebungen des Bitkom und des KfW Research zum allgemeinen Start-up-Ökosystem unmissverständlich, dass Wagniskapital heute primär in DeepTech fließt.

Der absolute technologische Haupttreiber des Sektors ist die angewandte künstliche Intelligenz, dicht gefolgt von Spatial Computing. Während der Krypto- und Blockchain-Hype der frühen 2020er Jahre einer harten Marktkorrektur gewichen ist, dominieren nun handfeste B2B-SaaS-Lösungen und KI-gestützte Computer-Vision-Modelle das Feld. Die Unit Economics haben sich branchenweit stabilisiert. Investor*innen vergeben wieder signifikante Runden an Start-ups, die nachweislich die Leistung von Athleten steigern oder die Monetarisierung von Fan-Daten messbar optimieren können – und zwar ohne dabei in die hochriskante und teure Hardware-Falle zu tappen.

Die neuen Treiber (Sub-Sektoren): Vom Feld direkt in die Cloud

Wer heute noch versucht, eine weitere reine Fitness-Community-App zu bauen, erntet in den Boardrooms der VCs nur noch ein müdes Lächeln. Der Markt wird von hochspezifischen Sub-Sektoren getrieben, die tief in die Wertschöpfungskette des Sports eingreifen. Der dominierende Bereich ist „Markerless Computer Vision“, bei dem Kameras ohne am Körper getragene Sensoren jede Bewegung präzise erfassen und KI-Modelle Verletzungsrisiken prädiktiv berechnen.

Ein weiterer explosiver Treiber ist das „Immersive Fan Engagement“, wo Spatial Audio und Augmented Reality Stadionbesuche für globale Fans virtuell erlebbar machen.

Schließlich dominiert der „Hybride E-Sport“, bei dem physische Leistung nahtlos mit In-Game-Mechaniken verknüpft wird. Etablierte Pioniere wie das Münchner Vorzeige-Unternehmen Kinexon, das mit seiner präzisen Tracking-Hardware und Taktik-Software längst die NBA und Bundesliga erobert hat und branchenintern als heißer Anwärter auf den Unicorn-Status gehandelt wird, haben hierfür den Weg geebnet und gezeigt, dass deutsche DeepTech-Lösungen globale Standards setzen können.

Reality Check: Der teure Spiegel der Wahrheit

Doch der Weg in den Sport-Olymp ist gepflastert mit den Ruinen überhypter Geschäftsmodelle. Das einst prominenteste Mahnmal ist der tiefe Fall von Connected-Fitness-Hardware-Anbietern wie VAHA. Der smarte Fitness-Spiegel aus Berlin scheiterte an der Post-Covid-Realität und wurde Ende 2022 im Rahmen eines Fire-Sales veräußert. Ebenso zerschellten Krypto-Träume an der harten Marktwirklichkeit: Das Münchner Start-up The Football Club (TFC), gegründet 2020, das den Fußballfandom mit NFT-Avataren revolutionieren wollte, ging bereits 2023 nach dem Platzen der Blockchain-Blase in die Insolvenz.

Fast zeitgleich musste mit Coachinho (Gründung 2021) ein weiteres ambitioniertes Software-Projekt die Segel streichen: Die KI-basierte Pose-Detection-App für Amateurkicker versprach digitale Profi-Expertise via Smartphone-Kamera, ging jedoch trotz Unterstützung der NRW.Bank Ende 2023 in die Knie – der Spagat zwischen komplexer Computer-Vision-Technologie und einer nachhaltigen Monetarisierung im Breitensport erwies sich als zu groß.

Zwei brandaktuelle Dramen erschütterten die Branche jedoch erst kürzlich. Zum einen musste das Jenaer Start-up Coachwhisperer (Gründung 2021) im Frühjahr 2026 zum Amtsgericht – die brutalen Entwicklungskosten ihrer In-Ear-Hardware hatten Millionen verschlungen. Zum anderen endete der gewaltige Hype der Kölner Baller League (Gründung 2023). Das hybride Medienunternehmen mischte den Markt durch Twitch-Kultur und Influencer zunächst radikal auf, doch nachdem Hauptsponsoren wie XING absprangen und Prominente sich zurückzogen, musste der deutsche Ligabetrieb im Januar 2026 eingestellt werden.

Aus solchen Crashs lassen sich vier fatale Fallstricke ableiten:

- Die Hardware-Falle. Wer auf physische Geräte setzt (wie VAHA oder Coachwhisperer), unterschätzt die Komplexität und Kapitalintensität der Produktion.

- Die toxischen Customer Acquisition Costs. Im B2C-Geschäft und bei reinen Hype-Formaten explodieren Marketing- und Influencer-Ausgaben so schnell, dass sie jegliche Margen auffressen.

- Die Churn-Rate-Illusion. Wenn der anfängliche Hype verfliegt (wie bei TFC oder der Baller League), kündigen Nutzer*innen Abos und Sponsoren springen ab.

- Der regulatorische und technologische Blindflug. Wer – wie Coachinho – biomechanische Daten per Kamera verarbeitet, scheitert in Europa nicht nur an der extremen technologischen Hürde, sondern oft auch an den strengen DSGVO-Vorgaben, wenn Privacy-by-Design nicht vom ersten Tag an verankert ist.

Das deutsche Netzwerk (Hotspots)

Die deutsche Szene konzentriert sich auf hochspezialisierte urbane Hubs, die eine perfekte Symbiose aus Forschung, Kapital und Industrie bieten. München thront dank der Technischen Universität (TUM) und der Innovationsmaschinerie der UnternehmerTUM unangefochten an der Spitze, wenn es um DeepTech, Sensortechnik und Wearables geht. Berlin bleibt das unbestrittene Epizentrum für E-Sports und Fan-Engagement, angetrieben durch die Präsenz globaler Player wie Riot Games, Mega-Organisationen wie G2 Esports und ein dichtes Netz an Kreativagenturen. Köln hat seine historische Stärke als Sitz der Deutschen Sporthochschule (DSHS) sowie der ESL genutzt, um sich als europäischer Hotspot für sportwissenschaftliche Start-ups und Live-Event-Technologien zu etablieren. Leipzig komplettiert das Quartett; angetrieben durch den SpinLab Accelerator hat sich die Stadt eine exzellente Nische im Bereich E-Health, Reha-Technologien und digitaler Prävention im Spitzensport erarbeitet.

Investor*innen-Radar

Das Kapital fließt aus hochspezialisierten Quellen. Bei den dedizierten VCs führt global kein Weg an BITKRAFT Ventures vorbei; der Fonds mit starken Berliner Wurzeln ist der absolute Königsmacher im E-Sports- und Web3-Gaming-Segment. Ergänzt wird dies durch Spezialisten wie leAD Sports & Health Tech Partners, die gezielt Frühphasen-Start-ups skalieren. Auch die Top-Tier Generalisten haben Blut geleckt: Earlybird und Cherry Ventures platzieren zunehmend Wetten auf B2B-SaaS-Modelle, die Sportdaten monetarisieren. Auf industrieller Seite dominieren Corporate VCs wie Porsche Ventures, die in Performance-Tech investieren, sowie Adidas, die nach digitalen Fitness-Ökosystemen suchen. Der wahre Motor der Frühphase sind jedoch erfahrene Business Angels. Prominente Köpfe aus dem echten Sport wie Mario Götze, Julian Draxler oder Oliver Bierhoff haben sich längst als smarte Co-Investoren etabliert, die nicht nur Kapital, sondern unbezahlbaren Zugang zu Vereinen und Athlet*innen mitbringen.

Die Top Start-ups (Must-Watch)

Für die Auswahl der Top-Start-ups in diesem Report haben wir strenge Kriterien angelegt. Alle beleuchteten Unternehmen sind ausschließlich deutsche Start-ups, deren Gründung im Jahr 2020 oder später erfolgte. Wir bewerten nicht nach den lautesten Marketing-Kampagnen, sondern nach vier harten Metriken: belegbare Marktrelevanz, die Tiefe der technologischen Innovation (Reifegrad), Diversität in den Geschäftsmodellen und Gründungsteams sowie das nachgewiesene Vertrauen hochkarätiger Investor*innen. Zudem floss die Skalierbarkeit des jeweiligen Ansatzes maßgeblich in die finale Bewertung ein.

Prematch (Gründung 2021)

Das Kölner Gründer-Trio Lukas Röhle, Fiete Grünter und Niklas Brackmann hat mit Prematch den „Transfermarkt für den Amateurfußball“ erschaffen. Das B2C- und B2B-Plattform-Modell bündelt Spieldaten, News und Statistiken bis in die tiefsten Amateurligen. Der USP liegt in der gigantischen, hochaktiven Basisdaten-Sammlung, die auch für Werbetreibende extrem wertvoll ist. Zuletzt flossen Millionen in mehreren Runden, angeführt von namhaften Business Angels: Neben den Profis Serge Gnabry und David Raum stieg auch das Family Office von Jürgen Klopp sowie Weltmeister Toni Kroos als strategischer Investor ein.

Dyn Media (Gründung 2022)

Unter der Vision des ehemaligen DFL-Chefs Christian Seifert und der operativen Führung von CEO Andreas Heyden revolutioniert Dyn Media als B2C-Streaming-Plattform die Sichtbarkeit von Sportarten jenseits des Fußballs. Der technologische USP liegt in einer hochmodernen, Cloud- und KI-gestützten Produktionsinfrastruktur, die Übertragungskosten drastisch senkt. Als absoluter Vertrauensbeweis der Branche gilt das starke Fundament des Medienprojekts: Das Joint Venture mit dem Medienriesen Axel Springer sichert der Plattform langfristig die nötige Finanzkraft und eine enorme mediale Reichweite.

Exakt Health (Gründung 2021)

Das von Philip Billaudelle und Lucia Payo in Berlin gegründete Start-up Exakt Health liefert den perfekten Gegenentwurf zur überhypten Fitness-Hardware. Das B2C-SaaS-Modell ist als echtes, zertifiziertes Medizinprodukt (MDR) zugelassen und bietet eine physiotherapeutische App für Sportverletzungen. Der USP liegt in den adaptiven, KI-gestützten Trainings- und Rehaplänen, die auf strengen medizinischen Leitlinien basieren. Dieses tiefe technologische Fundament sicherte dem Team Millionen-Investments von starken Lead-Investoren wie der Barmenia Next Strategies sowie von erfahrenen Engeln wie dem N26-Gründer Maximilian Tayenthal.

Enduco (Gründung 2020 / Neustart 2024)

Die Geschichte von Enduco ist die ultimative „Phönix aus der Asche“-Story der Szene. Ursprünglich 2020 gegründet und vom High-Tech Gründerfonds (HTGF) finanziert, musste die GmbH Mitte 2024 Insolvenz anmelden. Doch statt aufzugeben, formierte das Team um Mitgründer Lennard Schäfer das B2C-SaaS-Modell unter dem neuen Firmendach der endurance coach GmbH radikal neu. Die App bietet Ausdauersportlern eine Trainingsplanung, die mithilfe von maschinellem Lernen auf Vitaldaten reagiert – ein handfester Beweis, dass echte technologische Substanz harte Unternehmenskrisen überdauern kann.

Internationaler Ausblick & Fazit

Wer den Blick über den europäischen Tellerrand wagt, erkennt drei globale Makro-Trends, die den deutschen Markt in Kürze mit voller Wucht treffen werden. Aus den USA schwappt die Welle des „Markerless Tracking“ herüber, bei dem reine Smartphone-Kameras genügen, um durch komplexe KI-Berechnungen vollständige biomechanische Profile zu erstellen – der Anfang vom Ende der klobigen Wearables. Asien dominiert derweil die Entwicklung von KI-generierten Live-Kommentatoren und hyperrealistischen Avataren, die E-Sports-Übertragungen in dutzenden Sprachen gleichzeitig und vollautomatisiert moderieren. Aus dem DeepTech-Hub Israel drängen Start-ups auf den Markt, die neurokognitives Bio-Feedback nutzen, um die Reaktionszeiten von Profisportlern durch Gehirnstrom-Analysen messbar zu verkürzen.

Das Fazit für Gründer*innen und Investor*innen: Bunte Community-Apps ohne echten technologischen Burggraben haben in der SportTech-Branche keine Überlebenschance mehr. Gewinnen wird, wer harte DeepTech-Lösungen im B2B-Bereich etabliert, echte Leistungsprobleme durch Daten löst und verstanden hat, dass der Sport der Zukunft im Code entschieden wird.

Von der Risikoanalyse zur echten Rendite: Wie Resilens den Markt für Klimaanpassung knacken will

Ein zu erwartender Hitzesommer reiht sich nahtlos an den nächsten, und die spürbaren Klimarisiken für Städte, Institutionen und Unternehmen wachsen rasant. Doch während die Investitionsbedarfe steigen, gerät die Umsetzung oft ins Stocken: Es fehlen bislang effiziente Verfahren, um abstrakte Gefahren in finanzierbare Investitionspläne zu übersetzen. Genau an diesem Flaschenhals setzt die neue Plattform Resilens an. Das 2026 von Dr. Oliver Marchand, Stephan Heuel und Christian Schmelter gegründete schweizerisch-deutsche Start-up verspricht nicht weniger als den Paradigmenwechsel vom reinen Klimarisiko hin zum messbaren „AdaptationReturn“. Wir nehmen das Geschäftsmodell, die Köpfe dahinter und die Hürden des Unternehmens unter die Lupe.

Die Macher hinter der Resilens UG sind in der europäischen ClimateTech-Szene keine Unbekannten. CEO und Mitgründer Dr. Oliver Marchand hat mit seinem vorherigen Start-up Carbon Delta – das 2019 erfolgreich vom Finanzdienstleister MSCI übernommen wurde – bereits bewiesen, wie man wissenschaftlich fundierte Klimamodelle kommerzialisiert. Das Team vereint gezielt Technologie und Vertrieb: Neben Marchand treiben Stephan Heuel als CTO und Christian Schmelter als CCO die Entwicklung voran.

Doch warum wagt das Team rund sieben Jahre nach dem MSCI-Exit eine neue Gründung? Gegenüber unserem Magazin betont Marchand, dass sich der Markt in der Zwischenzeit fundamental gewandelt habe. Bei Carbon Delta habe man noch Pionierarbeit geleistet und Klimarisiken für Finanzmärkte überhaupt erst messbar gemacht. „Heute stehen wir vor dem nächsten Schritt: Wir müssen aus Risikoanalysen konkrete Investitionsentscheidungen machen“, erklärt der Gründer.

Städte und Betreiber kritischer Infrastruktur wüssten heute sehr wohl, dass sie handeln müssen, könnten aber oft nicht systematisch beantworten, welche Maßnahmen den größten Nutzen bringen und wirtschaftlich sinnvoll sind. Klimaanpassung sei kein reines Zukunftsthema mehr, sondern harte operative Realität. „Damals haben wir Risiken messbar gemacht. Jetzt geht es darum, aus diesen Daten echte Entscheidungen abzuleiten“, so Marchand.

Binationale Strategie: Zwischen Finanzplatz und Klimaforschung

Auffällig bei Resilens ist die binationale Aufstellung mit Standorten in Zürich und Potsdam. Für Marchand ist das strategisches Kalkül: Zürich diene mit der Nähe zur ETH, dem Technopark und einem starken Finanzökosystem als Brutstätte. Potsdam wiederum sei durch die Universität und das Institut für Klimafolgenforschung ein bedeutender wissenschaftlicher Hotspot. Zudem sei der deutsche Markt für den öffentlichen Sektor zentral, da Klimaanpassung dort gerade zur operativen Daueraufgabe wird.

Finanziert wird das junge Unternehmen durch Eigenmittel und das Kapital des strategischen Investors Karl Gutbrod. Dieser hat mit meteoblue einen der renommiertesten Anbieter für Klimadaten aufgebaut. Das sei weitaus mehr als reines Risikokapital, unterstreicht Marchand: „Es ist ein klares Signal aus dem Klimadatenmarkt, dass der nächste logische Schritt jetzt die Übersetzung dieser Daten in Entscheidungen ist.“

Die Plattform ist seit Anfang Mai live und durchläuft aktuell die ersten Praxisphasen. Der ehrgeizige Fahrplan für die nächsten Monate steht: Zunächst startet die Software mit dem Thema Hitze, zur Jahresmitte folgen Überschwemmungen, danach Sturm und Trockenheit. Der geografische Fokus liege zunächst auf dem deutschsprachigen Raum, Benelux und den nordischen Ländern, so der CEO, schiebt jedoch mit Nachdruck hinterher: „Langfristig denken wir global. Klimaanpassung ist kein europäisches Spezialthema.“

Der AdaptationReturn als künftiger Branchenstandard?

Das klassische Problem der Klimaanpassung ist finanzieller Natur: Während sich der Return on Investment (ROI) bei der CO₂-Reduktion verhältnismäßig leicht messen lässt, bleibt die wirtschaftliche Rendite von Schutzmaßnahmen schwer fassbar. Anstatt nur Gefahrenzonen farblich zu markieren, will Resilens Kommunen und Unternehmen softwarebasiert helfen, Maßnahmen standortbezogen zu bewerten und belastbare Pläne zu priorisieren. Das Herzstück dieser Kalkulation ist der neue KPI „AdaptationReturn“.

Der Paradigmenwechsel im Überblick:

Kriterium | Bisheriger Marktstandard | Der Resilens-Ansatz |

Fokus | Risikoanalyse (Was passiert wo?) | Handlungsplanung (Was tun wir?) |

Bewertung | Langwierige Consulting-Projekte | Softwarebasierte Priorisierung von Maßnahmen |

Zentrale Metrik | Abstraktes Schadenspotenzial | „AdaptationReturn“ (Belastbare Anpassungspläne) |

Doch wie belastbar kann eine solche Metrik angesichts hochvolatiler Wetterextreme wirklich sein? Auf die kritische Nachfrage, ob das Tool womöglich nur theoretische Best-Case-Szenarien produziere, um Investor*innen zu beruhigen, räumt Marchand unumwunden ein: „Die Volatilität ist real, und genau deshalb bauen wir AdaptationReturn so, wie wir ihn bauen.“ Man verkaufe ganz bewusst keine rosigen Szenarien, sondern eine konservative, prüfbare Entscheidungsgrundlage, die auf etablierten ökonomischen Methoden basiere.

Die Software setze auf maximale Transparenz. „Nehmen Sie ein begrüntes Dach: Es kühlt das Gebäude, speichert Regenwasser, schafft Lebensraum für Insekten und verlängert die Lebensdauer der Dachkonstruktion“, veranschaulicht Marchand das Prinzip. Jeder dieser Vorteile werde einzeln und ohne versteckte Blackbox ausgewiesen, sodass Anwender selbst entscheiden können, welche Faktoren in die Rechnung einfließen.

Das System rechne dabei konsequent konservativ mit wissenschaftlich kaum bestreitbaren Mindestpreisen und warne explizit auch vor Fehlinvestitionen. „Ein belastbarer Business Case zeigt nicht nur, was funktioniert, sondern auch, was nicht funktioniert“, kontert der Gründer.

Bewährungsprobe im B2G-Sektor und die leeren Kassen

Dass die Theorie auch im harten Alltag standhält, zeigt ein Pilotprojekt mit der Stadt Worms, eingebettet in das EU-Programm Pathways2Resilience. Derartige Best-Practice-Beispiele sind überlebenswichtig. Denn Kommunen sind wegen ihrer langwierigen Vergabeverfahren (B2G) berüchtigt und fordern von Start-ups einen extrem langen finanziellen Atem.

Neben dem öffentlichen Sektor bedient Resilens aber auch Industrieunternehmen. Was diese völlig unterschiedlichen Zielgruppen vereint, ist ein neues Berufsbild: das des Klimaanpassungsmanagers. Diese Fachkräfte hätten zwar viele Daten, aber kaum standardisierte Tools. In Worms, wo ein Pilot zum Hitzeschutz für 55 Kitas läuft, zeige sich das Dilemma deutlich. „Die zentrale Frage ist dort nicht, ob Hitze ein Problem ist. Die Frage ist: Welche Einrichtung zuerst, welche Maßnahme, in welcher Reihenfolge“, unterstreicht Marchand. Entscheidend sei, dass Analysen standortbezogen und extrem schnell – in Tagen statt Monaten – vorliegen und sich leicht gegenüber der Politik kommunizieren lassen.

Selbst der perfekt kalkulierte Plan stößt jedoch an Grenzen, wenn am Ende das städtische Budget für die Schutzbauten fehlt. Dem realen Problem knapper Kassen weicht Marchand nicht aus, ordnet es aber anders ein: Geld sei zwar knapp, doch es fließe heute meist einfach nicht systematisch in die effektivsten Projekte.

Zudem verbiete es sich, Klimaanpassung als reine Kostenstelle abzutun. Marchand verweist auf eine Auswertung des Schweizer Bundesamts für Umwelt anhand von 81 Piloten: „Das durchschnittliche Nutzen-Kosten-Verhältnis lag bei 4,7. Kein einziges Projekt lag unter 1,0 und war somit unwirtschaftlich.“ Die Krux liege also nicht in der mangelnden Rentabilität, sondern an deren schwieriger Darstellbarkeit. Gelinge der saubere Business Case, würden sich auch alternative Finanzierungen wie PPP-Modelle oder Versicherungsgelder auftun.

Fazit

Mit Resilens drängt kein naiver Newcomer auf den Markt. Das erfahrene Team adressiert zielgenau einen der größten Schmerzpunkte der ClimateTech-Branche: Die fehlende Übersetzungsleistung zwischen dem nackten Risiko und dessen finanzierbarer Lösung. Zwar ist die Etablierung eines völlig neuen, globalen Standards wie dem AdaptationReturn politisch wie wirtschaftlich ein extrem dickes Brett. Gelingt es dem schweizerisch-deutschen Start-up jedoch, die zähen Vertriebszyklen im öffentlichen Sektor zu überstehen, könnte es im boomenden Markt der Klimaanpassung künftig eine zentrale Schlüsselrolle spielen.

Vom Corona-Hilfsprojekt zur Tech-Plattform: BON BON greift nach dem Gastro-Gutscheinmarkt

Wie sich das Hamburger GastroTech-Start-up BON BON der Gründer David Bernhard, Patrick Kosmala und Malte Steiert neu positioniert und mit smarten Kassen-Schnittstellen den 10-Milliarden-Gutscheinmarkt erobern will.

Steigende Kosten, kurzfristige Reservierungsabsagen und eine spürbare Konsumzurückhaltung setzen die deutsche Gastronomiebranche im Jahr 2026 massiv unter Druck. In diesem Klima positioniert sich das Hamburger GastroTech-Unternehmen BON BON mit einem Plattform- und Markenrelaunch neu. Der Plan des Start-ups: Es will sich vom reinen Gutscheinanbieter zum Technologie- und Infrastrukturpartner der Branche wandeln. Damit rückt der deutsche Gutscheinmarkt, der ein jährliches Gesamtvolumen von rund zehn Milliarden Euro aufweist, ins strategische Visier der Hanseaten.

Pandemie-Baby wird erwachsen: Der Weg ins B2B-Geschäft

Die Wurzeln von BON BON liegen in der Corona-Pandemie. Das Start-up ging aus der Solidaritäts-Initiative PayNowEatLater hervor, die 2020 als digitaler Rettungsschirm ins Leben gerufen wurde. Was als Hilfsaktion durch die vier Gründer David Bernhard, Patrick Kosmala, Niclas Störmer und Malte Steiert begann, verbindet heute gastronomische Betriebe mit Endverbraucher*innen und Firmenkund*innen.

Der Weg vom provisionsfreien Projekt zur B2B-Plattform ist jedoch ressourcenintensiv. Auf die Frage, wie dieser Sprung finanziert wurde und ob Venture Capital im Spiel war, erklärt Co-Gründer David Bernhard: „Tatsächlich konnten wir die Dynamik und den Rückenwind aus der Corona-Zeit nutzen, um die Weiterentwicklung aus eigener Kraft zu finanzieren. Dadurch ist BON BON bis heute vollständig bootstrapped und wir können unabhängig von externem Investorendruck unsere langfristige Vision verfolgen.“

Kassen-Schnittstellen: Der technische Umbau

Der strategische Kern der Neuausrichtung ist der Ausbau nativer Schnittstellen zu Kassen-Systemen (POS). Durch diese Systemintegration sollen Gutscheine automatisiert direkt am Tresen validiert und verbucht werden. Das Unternehmen gibt an, damit den administrativen Aufwand im operativen Alltag der Betriebe drastisch senken zu wollen. Die Gutscheine selbst sind deutschlandweit in über 10.000 Partner*innen-Betrieben einlösbar – von der Kiez-Gastronomie bis zur 3-Sterne-Küche.

Der Aufbau dieses Netzwerks sei laut Unternehmen ein zentraler Schritt gewesen. Rund 1.500 Gastronomien stammen noch direkt aus der Pandemie-Phase, der Rest sei organisch durch Empfehlungen, Messen und den Ausbau von Einzelbetrieben hin zu Ketten gewachsen.

Bezüglich der Abwanderungsquote im Wettbewerb verweist der Gründer auf das eigene Angebot: „Die Churn-Rate zu alternativen Angeboten ist bei uns sehr gering, da unser Leistungsversprechen und die erzielbaren, klar messbaren Ergebnisse für die Gastronomien äußerst überzeugend sind. Die häufigsten Gründe für Abgänge sind tatsächlich Insolvenzen oder Geschäftsaufgaben – bedingt durch die insgesamt herausfordernde wirtschaftliche Lage in der Gastronomie.“

Monetarisierung und Social Impact

Begleitet wird diese Entwicklung durch eine visuelle Neuausrichtung, für die das Unternehmen eine Food-Branding-Agentur engagiert hat. Zudem setzt BON BON auf eine Social-Impact-Komponente: Pro verkauftem Gutschein fließen 0,25 Euro an die Welthungerhilfe zur Finanzierung von Schulmahlzeiten in Burundi.

Hinsichtlich der Monetarisierung legt Bernhard dar, wie sich das Zwei-Säulen-Modell der Hamburger rechnet: „Hier profitieren wir stark davon, dass unser Geschäftsmodell auf zwei Säulen basiert: Zum einen unser Gutscheinsystem inklusive POS-Integrationen für Gastronomien, über das sie ihre eigenen Gutscheine verkaufen und verwalten können – wobei unsere Marge hier bewusst sehr gering ist. Der strategisch wichtigere Bestandteil ist der BON BON Universalgutschein, der bei allen Partner-Gastronomien eingelöst werden kann.“

Die Erlöse generiert das Unternehmen dabei vor allem über das Firmenkund*innengeschäft. „Einnahmen erzielen wir hier insbesondere über unsere B2B-Lösungen, etwa automatisierte Gutscheinversendungen zu Anlässen wie Geburtstagen, sowie über die branchenübliche Nichteinlösequote, die bei Gutscheinsystemen immer eine Rolle spielt“, so der Gründer weiter.

Der Kassenmarkt als operative Hürde

Der Gutschein-Sektor ist stark fragmentiert und umkämpft. Im Erlebnisbereich agieren Anbieter wie Jochen Schweizer, im Gastro-Segment Akteure wie Yovite oder subventionierte Stadtgutschein-Initiativen.

Eine wesentliche operative Hürde für BON BON liegt in der technologischen Zersplitterung der Branche. Gefragt nach der technischen Herausforderung, funktionierende Schnittstellen von Orderbird über Vectron bis Lightspeed trotz Software-Updates stabil zu halten, räumt Bernhard ein: „Das ist tatsächlich eine große Herausforderung, der wir mit sehr langfristig aufgebauten und partnerschaftlichen Beziehungen sowohl zu den Kassensystemanbietern als auch zu den Gastronom*innen begegnen. Erfreulicherweise sind die relevanten Schnittstellen dabei vergleichsweise stabil und weitgehend von den schnellen Entwicklungszyklen der eigentlichen Kassensoftware entkoppelt, was uns eine verlässliche technische Integration ermöglicht.“

Ausblick auf die kommenden Monate

Ob es dem Team langfristig gelingt, den Betrieben bürokratische Hürden im Alltag durch POS-Integrationen abzunehmen, wird der Praxis-Test zeigen. Gleichzeitig muss sich beweisen, ob die überarbeitete Website und die mobile Nutzer*innenführung ausreichen, um Endkund*innenkäufe außerhalb typischer Phasen wie Weihnachten konstant zu generieren.

Für die kommenden 12 bis 18 Monate hat das Team Produkt-Schritte definiert. Bernhard benennt die geplante Expansion: „Die Weiterentwicklung geht hier klar in zwei Richtungen: Zum einen in die kontinuierliche Erschließung weiterer Supermarktketten, zum anderen vor allem in den Ausbau erweiterter Firmenangebote rund um steuerfreie Sachbezüge. Dabei ermöglichen wir es Arbeitgebenden – unter bestimmten Voraussetzungen, die wir dank unserer Kassensystem-Integrationen zunehmend zuverlässig erfüllen – ihren Mitarbeitenden monatlich oder zu besonderen Anlässen steuerfrei Gutscheine bereitzustellen.“

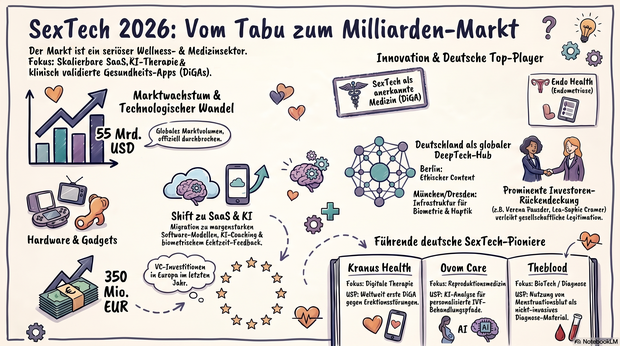

SexTech-Start-up-Report 2026

Vom Tabu zum 55-Milliarden-Markt: Wie KI und DeepTech die digitale Intimität revolutionieren und wer die führenden deutschen Start-ups in diesem Segment sind.

Noch vor wenigen Jahren reichte ein einfaches Erwähnen des Begriffs aus, um in gediegenen Investor*innenrunden für betretenes Schweigen oder nervöses Räuspern zu sorgen. Doch ist die Schmuddelecke von gestern einer der vielleicht spannendsten und margenstärksten Wachstumsmärkte von heute.

Wer als erfahrene(r) Wagniskapitalgeber*in den Aufstieg von FemTech und die Enttabuisierung von DeathTech aufmerksam verfolgt hat, weiß: Digitale Intimität ist der nächste logische, Milliarden schwere Schritt. SexTech hat sich als hochprofessioneller Wellness-Sektor etabliert, der menschliche Grundbedürfnisse mit DeepTech, künstlicher Intelligenz und medizinischer Präzision verknüpft.

Die Marktlage: Wenn Algorithmen die Intimität skalieren

Der globale Markt für sexuelles Wohlbefinden hat im Jahr 2026 die prognostizierte Marke von 55 Milliarden US-Dollar durchbrochen. Europa spielt dabei eine zentrale Rolle. Aktuelle Datenbank-Auswertungen belegen einen historischen Wendepunkt: Allein im vergangenen Jahr flossen weit über 350 Millionen Euro europäisches Risikokapital in Start-ups aus dem Bereich der sexuellen Gesundheit.

KI fungiert längst nicht mehr nur als Spielerei, sondern als Motor für hyperpersonalisierte Paartherapie-Bots, biometrisches Feedback in Echtzeit und empathische Begleitsysteme. Der Markt ist von reinen Hardware-Gadgets hin zu margenstarken Software-as-a-Service-Modellen migriert, was die Skalierbarkeit drastisch erhöht.

Reality Check: Die harten Fallstricke

Trotz des Hypes ist der Weg zum Exit gnadenlos. Das Scheitern von Pionieren hat gezeigt: Wer Hardware ohne Margen-Kontrolle baut oder die Datensicherheit vernachlässigt, scheitert sofort. Zudem bleiben „Vice Clauses“ bei Zahlungsdienstleistern und das algorithmische Shadowbanning auf Social-Media-Plattformen die größten Hürden. Wer hier skalieren will, muss die Community organisch binden.

Das deutsche Netzwerk: Die Hubs der Innovation

Deutschland hat sich global stark positioniert:

- Berlin: Das kulturelle Epizentrum für B2C-Plattformen und ethischen Content.

- München: Die DeepTech-Schmiede für biometrische Sensoren und Medizintechnik.

- Hamburg: Hub für Content-getriebene Marktplätze und E-Commerce-Expertise.

- Dresden/Leipzig: Aufstrebende Zentren für Haptik-Software und B2B-Infrastruktur.

Investor*innen-Radar: Wer das Tabu finanziert

Die Investor*innenlandschaft hat sich diversifiziert. Während spezialisierte VCs wie Amboy Street Ventures den Weg ebneten, investieren heute Generalisten wie Cherry Ventures oder HV Capital offen unter dem Label „Digital Health“. Den wichtigsten Treibstoff liefern jedoch Business Angels: Prominente Köpfe wie Verena Pausder und Lea-Sophie Cramer fungieren nicht nur als Kapitalgeber*innen, sondern als PR-Schutzschilde, die dem Thema gesellschaftliche Legitimation verleihen.

Die Top 10 Start-ups (Must-Watch 2026)

Die Auswahl der Top 10 basiert auf einer Analyse des Marktes im Mai 2026. Bewertet wurden Marktrelevanz, technologischer Reifegrad (AI/DeepTech), Diversität im Gründerteam und das Vertrauen namhafter Lead-Investor*innen. Es wurden ausschließlich Start-ups aufgenommen, die ab dem Jahr 2020 gegründet wurden, um den aktuellen Innovationszyklus abzubilden.

Cheex

Das Berliner Start-up wurde 2020 von Denise Kratzenberg und Maximilian Horwitz gegründet und ist heute der Leuchtturm für ethischen Content. Mit einem Subscription-Modell bietet Cheex Filme und Audios an, die Diversität und Konsens fokussieren. Anstatt klassischer VCs bewiesen hier starke Business-Angel-Syndikate und Netzwerke wie Collective Ventures früh massives Vertrauen.

Recoupling

Gegründet 2021 in Berlin von Jaane Henning, Tom Haubner und Johanna Lubig (welche heute jedoch operativ nicht mehr aktiv ist), nutzt die App psychologisch fundierte, KI-gesteuerte Coaching-Pfade, um die Kommunikation bei Paaren zu verbessern. Der technologische Kern analysiert Beziehungsmuster und erkennt Frühwarnsignale für Entfremdung. Recoupling sicherte sich Kapital namhafter Tech-Angels wie Bernd Heinrichs und Ingo Weber.

Bloom Stories

Das 2020 von Michael und Hannah Albertshauser gestartete Bloom Stories beweist die Macht von Audio-First-Erotik. Der USP ist die tiefe Immersion: Bloom Stories integrierte KI-Chatbots und bietet eine direkte Schnittstelle zu smarten Toys (wie Lovense), die ihre Vibration exakt an die Handlung der Audiospuren anpassen.

Kranus Health

Gegründet 2020 von Jens Nörtershäuser und Thilo Kleinschmidt, ist Kranus Health der Vorreiter für digitale Gesundheitsanwendungen (DiGA). Ihre App Kranus Edera ist die weltweit erste erstattungsfähige digitale Therapie gegen Erektionsstörungen. Top-Investor*innen wie der High-Tech Gründerfonds (HTGF) und Karista investierten früh Millionen in diesen medizinischen Ansatz.

Hapticlabs

Das 2021 in Dresden gegründete B2B-SaaS-Unternehmen (ein Spin-off der TU Dresden) Hapticlabs liefert Hersteller*innen ein „No-Code Haptics“-Toolkit. Entwickler*innen können damit komplexes Vibrationsfeedback für Hardware visuell programmieren. Diese essenzielle Infrastruktur für die nächste Generation von Intimprodukten zog früh DeepTech-Investor*innen an.

Frieda Health

Die 2022 von Valentina Ullrich in Hamburg gegründete Plattform Frieda Health besetzt das Segment „Silver Intimacy“. Frieda bietet eine digitale Telemedizin-Plattform für Frauen in der Menopause. Das enorme Potenzial erkannte der Maximon Longevity Co-Investment Fund, der die millionenschwere Pre-Seed-Runde anführte und die Brücke zum Megatrend Langlebigkeit schlug.

Ovom Care

Das 2023 in Berlin gegründete Start-up von Felicia von Reden, Dr. Lynae Brayboy und Dr. Cristina Hickman nutzt Machine Learning, um die Reproduktionsmedizin zu revolutionieren. Die Software analysiert klinische Daten für personalisierte IVF-Behandlungspfade. Investor*innen wie Alpha Intelligence Capital und Merantix unterstützen diesen DeepTech-Ansatz von Ovom Care massiv.

Endo Health

Das 2020 von der Ärztin Dr. med. Nadine Rohloff und Markus Rothenhöfer in Chemnitz und Berlin gegründete Endo Health adressiert eine der größten Versorgungslücken in der Frauengesundheit: Endometriose. Seit Januar 2026 ist die Endo-App als dauerhaft gelistete DiGA (Digitale Gesundheitsanwendung) anerkannt. Der technologische Kern der App kombiniert multimodale Schmerztherapie, physiotherapeutische Übungen und KI-gestütztes Symptom-Tracking. Durch die volle Erstattungsfähigkeit durch die Krankenkassen und die klinische Validierung ist Endo Health ein Musterbeispiel für die Transformation von SexTech hin zu evidenzbasierter Digital-Medizin.

Theblood

Dieses 2022 von Isabelle Guenou und Miriam Santer in Berlin gegründete BioTech-Projekt Theblood nutzt Menstruationsblut als nicht-invasives Diagnose-Material. Das Team wird durch RoX Health (das Accelerator-Studio von Roche) unterstützt, um hormonelle Dysbalancen und Biomarker systematisch auszuwerten.

Nevernot

Das 2020 von Anna Kössel und Katharina Trebitsch gegründete Start-up Nevernot skaliert durch Meisterschaft im digitalen Community-Building. Ursprünglich bekannt für Soft-Tampons, ist nevernot heute eine holistische Intim-Care-Plattform. Zu den Investoren zählen Branchengrößen wie Verena Pausder und Lea-Sophie Cramer.

Internationaler Ausblick & Fazit

Während Europa auf ethischen Content und Datenschutz setzt, formen Makro-Trends aus Übersee die nächste Stufe. Aus den USA schwappt die Neuro-Modulation herüber, in Asien beobachten wir die Perfektionierung emotionaler KI-Avatare, und Israel zementiert seinen Ruf durch Biotech-Start-ups, die sexuelle Dysfunktionen auf zellulärer Ebene behandeln.

Der Markt verzeiht keine unprofessionellen Bastellösungen mehr. Wer skalieren will, muss die Regulierungsbehörden genauso ernst nehmen wie die Endkunden. Für Investoren ist die Botschaft klar: Die Schamgrenze an der Tür zum Investmentkomitee stehen zu lassen, ist keine Frage der moralischen Offenheit, sondern schlichtweg harte finanzielle Pflicht. Wer diesen Sektor ignoriert, verpasst die lukrativste Schnittmenge aus Health, KI und menschlicher Natur.

Die digitale Infrastruktur-Hürde: Auffällig im Jahr 2026: Die Professionalisierung führt zu neuen Reibungspunkten. Dass Portale wie Cheex oft durch ISP-Filter blockiert werden oder theblood ihre Webpräsenz für klinische Zertifizierungsphasen (SGS-Kooperation) komplett umbauen, ist kein Zeichen von Schwäche, sondern ein Symptom der extremen regulatorischen Dichte. Der Markt ist erwachsen geworden – und mit ihm die Hürden für Sicherheit, Altersprüfung und klinische Evidenz.

Wer 2026 skalieren will, muss Regulatorik genauso ernst nehmen wie das Produkt. Investor*innen haben längst erkannt: SexTech ist kein moralisches Wagnis, sondern eine harte finanzielle Pflicht an der Schnittstelle von Health, KI und menschlicher Natur. Wer die „Website-Stille“ der klinischen Launch-Phasen als Scheitern deutet, verkennt die neue Ernsthaftigkeit einer Branche, die sich anschickt, das Gesundheitswesen dauerhaft zu verändern.

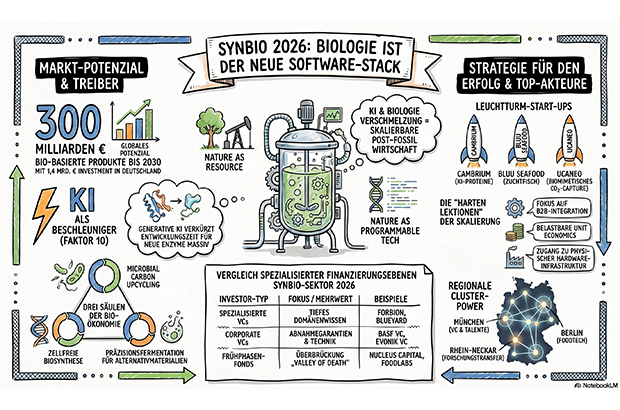

SynBio-Start-up-Report 2026

Biologie ist der neue Code: Wie Synthetische Biologie (SynBio) die Industrie neu programmiert und welche Start-ups dabei hierzulande federführend sind.

Die Vision einer post-fossilen Wirtschaft ist im Jahr 2026 keine bloße Utopie mehr, sondern eine präzise Ingenieursleistung. Wir erleben den Moment, in dem die Natur von einer Ressource, die wir ausbeuten, zu einer Technologie wird, die wir programmieren. In den Laboren der Republik entstehen heute Lösungen für die größten Versorgungskrisen unserer Zeit. Der Aufstieg der Synthetischen Biologie (SynBio) markiert den Übergang vom Zeitalter der Petrochemie in das Zeitalter der Biomanufaktur – eine Transformation, die so tiefgreifend ist wie die industrielle Revolution, jedoch mit der Geschwindigkeit der digitalen Transformation erfolgt.

Wenn Bits auf Atome treffen

Der SynBio-Markt ist 2026 in eine Phase der industriellen Skalierung eingetreten. Aktuelle Analysen der KfW sowie Branchenberichte von BCG beziffern das globale Marktpotenzial für bio-basierte Produkte bis Ende des Jahrzehnts auf über 300 Milliarden Euro. Allein in Deutschland ist das Investitionsvolumen in DeepTech-BioTech-Start-ups im vergangenen Geschäftsjahr laut Bitkom-Daten auf einen Rekordwert von 1,4 Milliarden Euro gestiegen. Der entscheidende technologische Katalysator ist die Verschmelzung von Generativer KI und Biologie. Dank Modellen, die Proteinfaltungen präziser vorhersagen können, als es je ein menschlicher Forscher vermochte, wurde die Entwicklungszeit für neue Enzyme um den Faktor zehn verkürzt. Die Biologie wird damit endgültig zum „Software-Stack“, bei dem Design-Build-Test-Learn-Zyklen in digitalisierten Bio-Gießereien automatisiert ablaufen.

Jenseits der Petrischale: Die Treiber der Bio-Ökonomie

Drei spezifische Sub-Sektoren dominieren in diesem Jahr die Agenda der Investor*innen. An erster Stelle steht die zellfreie Biosynthese, bei der komplexe Moleküle ohne den Einsatz lebender Zellen produziert werden, was die Skalierbarkeit massiv erhöht. Pioniere wie das US-Unternehmen Solugen haben hier den Weg geebnet, doch deutsche Akteure ziehen in der Effizienz der Bioreaktor-Steuerung nach. Ein zweiter massiver Treiber ist das Microbial Carbon Upcycling: Mikroben werden so programmiert, dass sie industrielles CO2 direkt in hochwertige Proteine oder Kunststoffe umwandeln. Hier verschmelzen Klimaschutz und Produktion zu einer Einheit. Drittens sehen wir den Siegeszug der Biomanufaktur bei Alternativmaterialien – sei es durch Biomasse-Fermentation für Lederersatz aus Myzel oder durch echte Präzisionsfermentation, bei der etablierte Akteure wie die bayrische AMSilk zeigen, dass programmierte Spinnenseide-Proteine bereits in Serie gehen können. Die Lieferkette der Mode- und Automobilindustrie wird durch diese Biopolymere radikal dekarbonisiert.

Die harten Lektionen der Skalierung

Der Weg zum Erfolg war jedoch von schmerzhaften Rückschlägen gepflastert. Der prominente Crash des einstigen Branchenlieblings Amyris im Jahr 2023 wirkt bis heute als warnendes Beispiel nach. Das Unternehmen scheiterte trotz Milliardenbewertung an der Komplexität der vertikalen Integration und dem Versuch, gleichzeitig Technologieplattform und B2C-Marke zu sein. Für heutige Gründer*innen haben sich daraus vier fatale Fallstricke herauskristallisiert, die über Sieg oder Niederlage entscheiden. Erstens: Die Ignoranz gegenüber den Unit Economics. Ein Produkt, das im 5-Liter-Maßstab funktioniert, muss im 50.000-Liter-Kessel nicht zwangsläufig profitabel sein. Zweitens: Das „Regulatorik-Vakuum“. Wer die EU-Novel-Food-Verordnungen oder GVO-Richtlinien nicht von Tag eins an in die Produktentwicklung einplant, riskiert Jahre des Stillstands. Drittens: Die Fokussierung auf den Endkonsument*innen statt auf B2B-Integration. Der wahre Hebel liegt in der Lizenzierung von Prozessen an die Industrie. Viertens: Die Unterschätzung der Hardware-Komponente. SynBio ist kein reines Software-Business; ohne Zugang zu physischer Infrastruktur bleibt jede Innovation im Labor gefangen.

Deutschlands Bio-Cluster

Deutschland hat sich im internationalen Vergleich als einer der stärksten Hubs für SynBio etabliert, getrieben durch eine einzigartige Verzahnung von Spitzenforschung und industrieller Basis. In München und dem angeschlossenen IZB Martinsried konzentriert sich die größte Dichte an Venture Capital und Talenten, eng flankiert durch die Exzellenz-Cluster der TU München. Berlin hat sich durch spezialisierte Inkubatoren wie den ProVeg Incubator, Atlantic Food Labs (FoodLabs) und den Science Park Berlin-Buch zum absoluten Zentrum für FoodTech und zelluläre Landwirtschaft entwickelt. Ein weiterer Hotspot ist das Rhein-Neckar-Delta rund um Heidelberg, wo das European Molecular Biology Laboratory (EMBL) und der BioRN-Cluster eine Brücke zwischen Grundlagenforschung und Marktreife schlagen. Aachen punktet mit der RWTH und einer starken Fokussierung auf Bio-Verfahrenstechnik, während der Raum Darmstadt/Frankfurt durch die Nähe zu Giganten wie Merck und die TU Darmstadt als Kraftzentrum für die industrielle Bioproduktion gilt.

Investor*innen-Radar

Die Finanzierungslandschaft hat sich spezialisiert. Wir unterscheiden im Jahr 2026 vier Ebenen der Kapitalgeber*innen. Die spezialisierten VCs wie Forbion, BlueYard Capital oder Sofinnova Partners bringen das notwendige tiefe Domänenwissen mit. Auf der zweiten Ebene stehen Top-Tier Generalisten wie HV Capital und Earlybird, die SynBio zunehmend als Teil ihrer Dekarbonisierungs-Strategie begreifen. Besonders kritisch für die Skalierung sind die Corporate VCs der Industrie, allen voran BASF Venture Capital und Evonik Venture Capital, die nicht nur Geld, sondern auch Abnahmegarantien und technisches Know-how bieten. In der Frühphase bewegen zudem spezialisierte Mikro-Fonds wie Nucleus Capital oder erfahrene ClimateTech-Angels den Markt, oft organisiert in Syndikaten, die das „Valley of Death“ zwischen Labor und Prototyp überbrücken

Die Top-Start-ups: Unsere Must-Watch-Liste 2026

Für die folgende Auswahl der Start-ups haben wir Unternehmen analysiert, die nach 2019 in Deutschland gegründet wurden. Die Auswahlkriterien basieren auf der technologischen Tiefe (IP-Portfolio), dem Reifegrad der Pilotierung, der Validierung durch renommierte Investoren sowie dem Potenzial, bestehende industrielle Lieferketten systemisch zu verändern. Diversität in Gründungsteams und die Skalierbarkeit der zugrunde liegenden Bio-Plattform waren weitere entscheidende Faktoren.

- Cambrium (Berlin, gegründet 2020): Das Team um Dr. Mitchell Duffy nutzt eine KI-gestützte Designplattform, um neuartige Proteine mit molekularen Funktionen zu entwickeln, die in der Natur so nicht vorkommen. Ihr Fokus liegt auf der Kosmetik- und Textilindustrie, wo sie petrochemische Inhaltsstoffe durch bio-designte Alternativen ersetzen. Mit massiven Finanzierungsrunden, angeführt von Tech-Schwergewichten wie Essential Capital und dem Google-KI-Fonds Gradient Ventures, gilt Cambrium als Leuchtturm für eine neue Generation von Biomaterial-Zulieferern, die aus digitalem Code physische Hochleistungsprodukte erschaffen.

- Bluu Seafood (Berlin, gegründet 2020): Gegründet von Dr. Sebastian Rakers und Simon Fabich, ist Bluu einer der führenden europäischen Akteure im Bereich kultivierter Fisch. Durch die Kultivierung echter Fischzellen im Bioreaktor adressieren sie die Überfischung der Meere. Nach signifikanten Investments durch Lead-Investor Sparkfood sowie LBBW VC und Delivery Hero Ventures steht das Unternehmen kurz vor der ersten Marktzulassung in Singapur und den USA.

- Colipi (Hamburg, gegründet 2022): Das Spin-off der TU Hamburg, geführt von Maximilian Webers, nutzt eine patentierte Gasfermentationstechnologie, um CO2 in nachhaltige Öle und Lipide umzuwandeln. Der USP von Colipi ist die Nutzung von industriellen Abgasströmen als Rohstoff, was die Produktion extrem kosteneffizient macht. Sie konnten sich frühzeitig die Unterstützung von Top-Investoren wie dem High-Tech Gründerfonds (HTGF) und dem Innovationsstarter Fonds Hamburg sichern.

- Kynda (Jelmstorf, gegründet 2019): Ursprünglich als Keen 4 Greens von Daniel MacGowan-von Holstein und Franziskus Schnabel gegründet, bietet Kynda Plug-and-Play-Fermentationssysteme für die Lebensmittelindustrie an. Als B2B-Technologiepartner stellen sie modulare Bioreaktoren und Pilzkulturen bereit, mit denen Hersteller ihre eigenen Produktionsabfälle direkt vor Ort kostengünstig in Mykoproteine umwandeln können. Eine kürzliche 3-Millionen-Euro-Seed-Finanzierung – angeführt vom VC EnjoyVenture und massiv flankiert durch ein strategisches Investment des Geflügel-Giganten PHW-Gruppe – unterstreicht das enorme Skalierungspotenzial dieses Kreislauf-Modells.

- Nosh.bio (Berlin, gegründet 2022): Das Team um Tim Fronzek nutzt Pilzbiomasse als funktionalen Inhaltsstoff für die Lebensmittelindustrie, um Clean-Label-Produkte ohne Zusatzstoffe zu ermöglichen. Der technologische Vorsprung von Nosh.bio liegt in der Geschwindigkeit des Fermentationsprozesses. Frühphasen-Finanzierungen durch Earlybird unterstreichen das hohe Vertrauen in das Skalierungspotenzial.

- Ucaneo (Berlin, gegründet 2022): Das Team um Florian Tiller und Carla Glassl beweist, dass Synthetische Biologie auch beim Direct Air Capture (DAC) den Unterschied macht. Statt energieintensiver chemischer Filter nutzt Ucaneo eine biomimetische Technologie: Sie setzen das Enzym Carboanhydrase ein – eines der schnellsten Enzyme der Natur –, um CO2 bei Raumtemperatur direkt aus der Umgebungsluft zu binden. Mit starken Frühphasen-Finanzierungen durch DeepTech-Fonds wie Nucleus Capital und der US-amerikanischen Grantham Foundation baut Ucaneo derzeit in Berlin-Marienfelde ihre erste industrielle Testanlage auf.

- Insempra (München, gegründet 2021): Das Team um Gründer Jens Klein hat sich zum Ziel gesetzt, die massive Abhängigkeit der globalen Lieferketten von der Petrochemie zu beenden. Über ihre B2B-Technologieplattform nutzen sie Präzisionsfermentation, um maßgeschneiderte Inhaltsstoffe für die Kosmetik-, Lebensmittel- und Textilbranche quasi zu programmieren – von bio-basierten Lipiden und Aromen bis hin zu neuartigen Proteinfasern. Eine hochkarätige Finanzierungsrunde, angeführt von europäischen DeepTech-Schwergewichten wie EQT Ventures und BlueYard Capital, unterstreicht den Anspruch von Insempra, ein globaler industrieller Zulieferer der nächsten Generation zu werden.

Ausblick & Fazit: Der globale Wettlauf

Der Blick über den Tellerrand zeigt: Wir stehen in einem globalen Systemwettbewerb. In den USA treibt die per Executive Order erlassene „National Biotechnology and Biomanufacturing Initiative“ Milliardeninvestitionen in die heimische Infrastruktur, flankiert von Pionieren, die dort und in Frankreich (wie Biomemory) bereits an der Verschmelzung von SynBio und DNA-Datenspeicherung arbeiten. In Asien, insbesondere in China und Singapur, werden derweil regulatorische Hürden in Rekordzeit abgebaut, um die Marktführerschaft bei der Biomanufaktur zu übernehmen. Flankiert wird dies von Hubs wie Israel, die mit massivem VC-Kapital den globalen Markt für kultivierte Proteine dominieren wollen.

Das Fazit für das Jahr 2026: Biologie ist die Infrastruktur der Zukunft. Für Gründer*innen bedeutet dies, dass die Zeit der reinen Plattform-Versprechen vorbei ist; gefragt sind konkrete Produkte und belastbare Unit Economics. Für Investor*innen bietet SynBio die seltene Chance, echte „Impact-Rendite“ zu erzielen, indem sie Industrien transformieren, die über Jahrzehnte festgefahren waren. Wer heute den Code der Natur versteht und skalieren kann, wird die Welt von morgen nicht nur verstehen, sondern neu bauen.

Württemberger Medien: Nachhaltige Wachstumsstrategien

Wie die Württemberger Medien Marketing Agentur Unternehmen mit datengetriebenen Strategien und klarer Positionierung unterstützt.

Digitale Sichtbarkeit ist heute für Unternehmen kein optionaler Erfolgsfaktor mehr, sondern eine Grundvoraussetzung. Märkte werden transparenter, Wettbewerber sichtbarer und Kunden anspruchsvoller. Wer sich behaupten will, muss nicht nur präsent sein, sondern gezielt kommunizieren, analysieren und optimieren. Genau an dieser Schnittstelle zwischen Strategie, Technologie und Kommunikation setzt die wtv Online Marketing Agentur an.

Das Unternehmen hat sich darauf spezialisiert, digitale Potenziale strukturiert zu erschließen und für seine Kunden messbar zu machen. Dabei geht es nicht um kurzfristige Maßnahmen oder einzelne Kampagnen, sondern um nachhaltige Strategien, die Wachstum langfristig unterstützen.

Von der Idee zur klaren digitalen Strategie

Viele Unternehmen starten mit einzelnen Marketingmaßnahmen, ohne eine übergeordnete Strategie zu verfolgen. Social-Media-Kanäle werden aufgebaut, Anzeigen geschaltet oder Inhalte produziert – oft ohne klare Zielsetzung oder langfristige Planung. Das Ergebnis: hohe Aufwände bei begrenzter Wirkung.

Die Württemberger Medien Agentur verfolgt bewusst einen anderen Ansatz. Im Mittelpunkt steht zunächst die Analyse. Bevor Maßnahmen umgesetzt werden, geht es darum, das Unternehmen, die Zielgruppe und den Markt genau zu verstehen.

Dazu gehören unter anderem:

- die Definition klarer Ziele und Zielgruppen

- die Analyse bestehender Marketingaktivitäten

- die Bewertung von Wettbewerbern und Marktposition

- die Identifikation von Potenzialen und Schwachstellen

Auf dieser Grundlage entsteht eine individuelle Strategie, die nicht nur kurzfristige Erfolge ermöglicht, sondern langfristig trägt.

Datenbasierte Entscheidungen statt Bauchgefühl

Ein wesentlicher Unterschied moderner Online-Marketing-Ansätze liegt in der Nutzung von Daten. Während Marketing früher oft stark von Erfahrung und Intuition geprägt war, stehen heute umfangreiche Analysemöglichkeiten zur Verfügung.

Die Württemberger Medien Agentur nutzt diese Möglichkeiten gezielt, um fundierte Entscheidungen zu treffen. Daten werden nicht nur gesammelt, sondern interpretiert und in konkrete Maßnahmen übersetzt. Dadurch lassen sich Maßnahmen kontinuierlich optimieren und Budgets effizient einsetzen.

Diese Arbeitsweise bringt mehrere Vorteile mit sich:

- bessere Planbarkeit von Marketingmaßnahmen

- transparente Erfolgsmessung

- gezielte Optimierung einzelner Kanäle

- langfristige Skalierbarkeit von Strategien

Gerade für wachsende Unternehmen ist diese Transparenz ein entscheidender Faktor.

Ganzheitlicher Blick auf digitale Kanäle

Online-Marketing besteht heute aus einer Vielzahl unterschiedlicher Disziplinen. Suchmaschinenoptimierung, Performance Marketing, Content-Strategie und Social Media greifen ineinander und beeinflussen sich gegenseitig.

Die Württemberger Medien Agentur betrachtet diese Bereiche nicht isoliert, sondern als Teil eines Gesamtsystems. Ziel ist es, die einzelnen Kanäle sinnvoll miteinander zu verknüpfen und so eine konsistente Markenkommunikation zu schaffen.

Dabei werden unter anderem folgende Bereiche integriert:

- Suchmaschinenoptimierung (SEO) für nachhaltige Sichtbarkeit

- Webdesign und Website-Entwicklung für einen professionellen digitalen Auftritt

- Digitale Mitarbeitergewinnung über zielgerichtete Online-Kampagnen

- Ganzheitliche strategische Beratung zur digitalen Sichtbarkeit und Kundengewinnung

Durch diese Verzahnung entsteht ein Marketingansatz, der sowohl kurzfristige Ergebnisse als auch langfristige Wirkung ermöglicht.

Fokus auf messbare Ergebnisse

Ein zentraler Anspruch der Württemberger Medien ist die Messbarkeit von Erfolg. Marketing wird nicht als kreativer Selbstzweck verstanden, sondern als strategisches Instrument zur Erreichung konkreter Unternehmensziele.

Das bedeutet, dass jede Maßnahme klar definierten Kennzahlen zugeordnet wird. Ob Traffic, Conversion-Rate oder Umsatz – die Ergebnisse werden kontinuierlich überprüft und ausgewertet.

Diese Transparenz schafft Vertrauen und ermöglicht es Kunden, ihre Investitionen nachvollziehbar zu steuern. Gleichzeitig bildet sie die Grundlage für eine kontinuierliche Weiterentwicklung der Strategie.

Zusammenarbeit auf Augenhöhe

Neben fachlicher Expertise spielt auch die Zusammenarbeit eine entscheidende Rolle. Die Württemberger Medien Agentur versteht sich nicht als externer Dienstleister im klassischen Sinne, sondern als strategischer Partner.

Das zeigt sich vor allem in der Kommunikation. Projekte werden eng mit den Kunden abgestimmt, Entscheidungen transparent getroffen und Entwicklungen regelmäßig besprochen. Ziel ist es, gemeinsam Lösungen zu entwickeln, die zum jeweiligen Unternehmen passen.

Diese partnerschaftliche Herangehensweise bringt mehrere Vorteile:

- klare Abstimmung von Zielen und Erwartungen

- schnelle Anpassung an Veränderungen

- langfristige Zusammenarbeit statt kurzfristiger Projekte

- bessere Integration in bestehende Unternehmensstrukturen

Gerade in dynamischen Märkten ist diese Flexibilität ein wichtiger Erfolgsfaktor.

Anpassungsfähigkeit in einem dynamischen Umfeld

Die digitale Welt verändert sich kontinuierlich. Neue Plattformen entstehen, Algorithmen werden angepasst und Nutzerverhalten entwickelt sich weiter. Für Unternehmen bedeutet das, dass Strategien regelmäßig überprüft und angepasst werden müssen.

Die Württemberger Medien Agentur begegnet dieser Dynamik mit einem flexiblen Ansatz. Statt starrer Konzepte setzt sie auf kontinuierliche Optimierung und Anpassung. Entwicklungen werden frühzeitig erkannt und in die Strategie integriert.

Dadurch bleiben Kunden nicht nur wettbewerbsfähig, sondern können neue Chancen aktiv nutzen.

Branchenübergreifende Erfahrung

Ein weiterer Vorteil der Württemberger Medien Online Marketing Agentur liegt in ihrer branchenübergreifenden Erfahrung. Zu den Kunden des Unternehmens zählen lokale und regionale Dienstleister, Handwerks- und Gewerbebetriebe sowie Unternehmen aus dem Mittelstand. Dadurch entsteht ein breites Verständnis für verschiedene Geschäftsmodelle, Zielgruppen und Marktmechaniken.

Diese Vielfalt hilft dabei, funktionierende Strategien nicht isoliert zu betrachten, sondern sinnvoll auf andere Bereiche zu übertragen. Was bei einem Dienstleistungsunternehmen zu mehr Sichtbarkeit und Anfragen führt, kann, richtig angepasst, auch für Handwerks- und Gewerbebetriebe sehr gut funktionieren. Gleichzeitig entstehen durch diese Perspektivwechsel oft innovative Ansätze, die über klassische Lösungen hinausgehen.

Dennoch bleibt jede Strategie individuell. Die Württemberger Medien Agentur setzt nicht auf standardisierte Konzepte, sondern passt Maßnahmen präzise an die jeweiligen Anforderungen an. Marktumfeld, Wettbewerbssituation und Zielgruppe werden dabei ebenso berücksichtigt wie interne Strukturen und Ressourcen des Kunden.

So entsteht ein ausgewogenes Verhältnis zwischen Erfahrung und Individualität – eine Kombination, die es ermöglicht, sowohl effizient als auch kreativ zu arbeiten und nachhaltige Ergebnisse zu erzielen.

Nachhaltiges Wachstum statt kurzfristiger Erfolge

Im Zentrum der Arbeit steht ein klares Ziel: nachhaltiges Wachstum. Während viele Marketingmaßnahmen auf schnelle Ergebnisse ausgerichtet sind, verfolgt die Württemberger Medien Agentur einen langfristigen Ansatz. Es geht nicht darum, kurzfristig Aufmerksamkeit zu erzeugen, sondern darum, stabile Strukturen aufzubauen, die dauerhaft funktionieren.