Aktuelle Events

Warum Fleisch, wenn es auch Sonnenblumen gibt?

Langsam, aber stetig entscheiden sich immer mehr Deutsche für weniger oder sogar gar keinen Fleischkonsum. Doch fleischlose Alternativen etwa auf Sojabasis haben keine reine Klimaweste. Das Münchner Start-up Planty Of Meat setzt daher auf Sonnenblumen und verspricht echten Fleischgeschmack.

Der Oktober 2022 war der wärmste seit Beginn der Wetteraufzeichnungen in Deutschland. Die hiesigen Sommer eilen seit Jahren von einem Temperaturrekord zum nächsten – während viele Ackerflächen, Waldböden und private Rasenflächen regelrecht verdorren. Es ist nicht mehr von der Hand zu weisen: Der Klimawandel ist im vollen Gange und verändert das Wetter hierzulande dramatisch.

Vor dem Hintergrund dieser Entwicklungen fragen sich mehr und mehr Deutsche nach der eigenen Rolle, dem eigenen Klima-Fußabdruck und ihrer persönlichen Verantwortung: Die Zahl der Menschen, die zumindest häufiger als früher vom Auto aufs Fahrrad umsteigen, nimmt zu. Und auch bei den Ess- und Verbrauchsgewohnheiten der Konsumentinnen und Konsumenten zeigt sich ein Umdenken. So geht der Fleischkonsum – wenn auch im internationalen Vergleich nach wie vor auf sehr hoher Basis – leicht zurück.

Fleischkonsum der Deutschen: Umdenken hat eingesetzt

Im Jahr 2021 summierte sich der menschliche Verzehr von Fleisch hier in Deutschland auf rund 55 kg pro Kopf, ist bei Statista nachzulesen. Weiter heißt es dort: „Der Gesamtverbrauch, in dem der Verbrauch von Tierfutter, die industrielle Verwertung sowie die Produktverluste berücksichtigt sind, summierte sich auf etwa 81,7 kg. Die in Deutschland am meisten konsumierte Fleischsorte ist Schweinefleisch. Es folgen Geflügel mit rund 13,1 kg sowie Rindfleisch mit etwa 9,4 kg pro Kopf. Die tendenziell sinkende Konsummenge von Fleisch in Deutschland ist vor allem auf die Zurückhaltung gegenüber dem Schweinefleisch zu erklären. Der durchschnittliche Gesamtverbrauch von Schweinefleisch sank seit dem Jahr 1991 um rund acht Kilogramm.“

Wesentliche Gründe für den Rückgang sind die zahlreichen Tierzuchtskandale der jüngeren Vergangenheit, Berichte über teils katastrophale Bedingungen bei der Haltung und dem Schlachten der Tiere, aber eben auch das steigende Bewusstsein über die immens hohen direkten und indirekten Kohlendioxid- und Methanemissionen bei der Nutztierzucht, die das Weltklima stark belasten.

Die Einsicht und der Wille zur fleischärmeren bis gar zur fleischlosen Ernährung ist bei vielen Menschen da. Wäre da nicht die Sorge, auf den dem Menschen regelrecht angeborenen Fleischgeschmack verzichten zu müssen.

Fleischersatz mit vollem Fleischgeschmack

Diese Sorge hatte auch Johannes Biel, als er 2019 das Unternehmen Planty Of Meat in Garching gründete: „Wir möchten natürlich konsumieren, gleichzeitig wollen wir unseren Kindern aber auch eine intakte Umwelt übergeben und nicht ohne Rücksicht auf Verluste leben.“ Als sich Johannes Biel mit dem Gedanken trug, eine „fleischlose Firma“ zu gründen, hatte er bereits als Fleischimporteur Karriere in der klassischen Industrie gemacht. Wie passt das zusammen? Seine Antwort: „Sicherlich sind wir ein Traditionsunternehmen, auf was wir sehr stolz sind. Dennoch möchten wir uns aber dem Zeitgeist nicht verwehren und auf aktuelle Trends eingehen. Folglich ist Planty Of Meat unsere Auflösung dieses Konflikts.“ Als Fleischimporteur kennt Biel die Bedürfnisse der Deutschen bestens – und will daher auch beim Geschmack keine großen Abstriche machen. Sein Motto: Was nach Fleisch schmeckt, muss kein Fleisch enthalten. Dabei will er aber keinen Zwang ausüben, sondern Optionen aufzeigen: mal mit, mal ohne Fleisch, je nach Lebenseinstellung, Lust und Laune.

Wettbewerber am Markt für fleischlose Produkte gibt es zahlreich. Als Fleischersatz bieten sich viele Dinge an: Tofu, Seitan, Soja. Tatsächlich enthalten Seitan und Soja beinahe genauso viel Eiweiß wie Fleisch, unverarbeitet aber kaum Fett und keine Harnsäure. Doch die gesunden Inhalte aus Soja und Weizen wie Vitamine, Mineralstoffe und Ballaststoffe werden bei der Eiweißgewinnung herausgelöst.

Planty Of Meat: Sonnenblumen mit weißerer Weste als Soja

Hinzu kommt auf der Negativbilanz: Das sehr proteinreiche und damit begehrte Soja erreicht mit keiner wirklich reinen Weste die deutschen Supermärkte und später die Teller der Verbraucherinnen und Verbraucher hierzulande. Für die Ausweitung der Ackerfläche werden etwa in Südamerika riesige Wald- und Savannenflächen umgewandelt. Auf diese Weise gehen einzigartige Lebensräume für Pflanzen und Tiere verloren, fruchtbarer Boden wird zerstört und Wasser verseucht.

Planty Of Meat dagegen setzt auf Fleischersatzprodukte auf Basis von Sonnenblumen und Weizen. Diese stammen nicht aus fernen Regionen und haben dadurch keine langen Transportwege hinter sich. Produziert wird in den Niederlanden.

Diese Artikel könnten Sie auch interessieren:

Produktivität statt Überstunden: Wie Echtzeitdaten das Finanzwesen von morgen steuern

Das KI-gestützte Fintech Embat beendet das Excel-Chaos im Treasury und macht Finanzteams mit Echtzeitdaten fit für die Zukunft.

Berlin, 28. April 2026 – Es ist ein bekanntes Bild in den Finanz- und Treasury-Abteilungen des deutschen Mittelstands: Wenn der Monatsabschluss naht oder Ad-hoc-Berichte für die Geschäftsführung benötigt werden, bleiben die Schreibtischlampen bis spät in die Nacht an. Die manuelle Zusammenführung von Daten aus unterschiedlichen Bankportalen und historisch gewachsenen Excel-Listen kostet nicht nur Nerven, sondern vor allem wertvolle Zeit.

Das schnell wachsende Fintech Embat tritt an, um genau diesen Engpass aufzulösen. André Reimers, Head of DACH, treibt diese Mission im deutschsprachigen Raum als Gesicht des Unternehmens voran. Seine Kernüberzeugung: Wer heute noch regelmäßig Überstunden machen muss, um finanzielle Transparenz zu schaffen, leidet nicht unter mangelnder Einsatzbereitschaft – er leidet unter einem strukturellen Datenproblem.

Beeindruckendes Wachstum durch das Lösen echter Pain Points

Dass der Schmerz in den Finanzabteilungen groß und der Bedarf an modernen Lösungen riesig ist, belegen die Zahlen, mit denen Embat den europäischen Markt aufrollt. Mit einem starken Kundenwachstum im deutschen Markt von über 250 Prozent im vergangenen Jahr und mittlerweile mehr als 400 mittelständischen und großen Unternehmenskunden weltweit hat sich das Fintech als fester Player etabliert. Das stetig wachsende Transaktionsvolumen von 250 Millionen Euro zeigt deutlich: Der Wechsel von fehleranfälligen Tabellen zu automatisierten Cloud-Lösungen ist in vollem Gange.

Der Weg aus der Excel-Falle

Mit seiner Technologie nimmt Embat den Kampf gegen ineffiziente Prozesse im Treasury auf. Anstatt hochqualifizierte Mitarbeiter mit repetitiver Datenpflege zu binden, automatisiert das System die Konsolidierung aller relevanten Finanzdaten.

„Die Erwartungshaltung, dass komplexe Finanzanalysen zwingend mit langen Abenden im Büro einhergehen müssen, ist schlichtweg nicht mehr zeitgemäß“, erklärt André Reimers. „Wenn Cashflow, Liquidität und Runways per Knopfdruck in Echtzeit abrufbar sind, ändert sich die gesamte Arbeitsdynamik. Finanzteams können aus dem reaktiven Modus heraustreten und sich auf die strategische Steuerung des Unternehmens konzentrieren.“

Hohe Innovationskraft trifft auf lokales DACH-Verständnis

Embat profitiert von einer enormen Innovationsgeschwindigkeit und Agilität, auf der die starke technologische Basis des Unternehmens beruht. Wie diese passgenau auf die spezifischen Bedürfnisse des deutschen Marktes übersetzt wird und für eine hohe lokale Marktpräsenz sorgt, zeigt André Reimers an den Standorten in München und Berlin.

Von diesen beiden Standorten aus steuert André Reimers das DACH-Geschäft und stellt das tiefe Verständnis für die komplexen Strukturen und hohen Sicherheitsbedürfnisse des deutschen Mittelstands sicher. Das Team zeigt dabei, wie moderne, dezentrale Zusammenarbeit erfolgreich funktioniert. Das Vertrauen der stetig wachsenden deutschen Kundenbasis fußt dabei auf dieser geballten lokalen Expertise gepaart mit der unerschütterlichen Zuverlässigkeit der Systeme.

Führen durch Resultate, nicht durch Anwesenheit

Die Botschaft an die Finanzwelt ist klar: Moderne Führung, hohe Produktivität und Skalierbarkeit erfordern keine starren Kontrollmechanismen oder endlosen Arbeitstage. Sie erfordern radikale Datentransparenz und die richtigen digitalen Werkzeuge. Wenn die Daten in Echtzeit fließen, sinkt die Fehlerquote, die Entscheidungsgeschwindigkeit steigt – und die systembedingten Überstunden im Treasury gehören endgültig der Vergangenheit an.

Über Embat:

Embat ist ein KI-gestütztes FinTech mit Schwerpunkt auf Treasury-Management, das es mittelständischen Unternehmen und Großkonzernen ermöglicht, ihre Finanzprozesse in Echtzeit zu zentralisieren. Gegründet von Antonio Berga und Carlos Serrano – ehemaligen J.P. Morgan-Managern mit umfassender Erfahrung im Corporate Banking – sowie Tomás Gil, dem ehemaligen CTO von Fintonic, entstand die Plattform mit der Mission, die Finanzabteilung zu digitalisieren. Die klare Prämisse dabei: Technologie von Finanzexperten für Finanzexperten.

Durch seine hybride Konnektivität lässt sich Embat in über 15.000 Banken und führende ERP-Systeme integrieren und beseitigt so jegliche Datenfragmentierung. Das wichtigste Alleinstellungsmerkmal ist TellMe, ein „Agentic Treasury Analyst“ (autonomer KI-Analyst), der Cashflow-Muster erkennt, komplexe Kontenabstimmungen automatisiert und strategische Entscheidungen zur Optimierung der Liquidität vorschlägt.

Mit Niederlassungen in Madrid, London, Berlin und München definiert Embat die Zukunft des Corporate Finance neu.

Württemberger Medien: Nachhaltige Wachstumsstrategien

Wie die Württemberger Medien Marketing Agentur Unternehmen mit datengetriebenen Strategien und klarer Positionierung unterstützt.

Digitale Sichtbarkeit ist heute für Unternehmen kein optionaler Erfolgsfaktor mehr, sondern eine Grundvoraussetzung. Märkte werden transparenter, Wettbewerber sichtbarer und Kunden anspruchsvoller. Wer sich behaupten will, muss nicht nur präsent sein, sondern gezielt kommunizieren, analysieren und optimieren. Genau an dieser Schnittstelle zwischen Strategie, Technologie und Kommunikation setzt die wtv Online Marketing Agentur an.

Das Unternehmen hat sich darauf spezialisiert, digitale Potenziale strukturiert zu erschließen und für seine Kunden messbar zu machen. Dabei geht es nicht um kurzfristige Maßnahmen oder einzelne Kampagnen, sondern um nachhaltige Strategien, die Wachstum langfristig unterstützen.

Von der Idee zur klaren digitalen Strategie

Viele Unternehmen starten mit einzelnen Marketingmaßnahmen, ohne eine übergeordnete Strategie zu verfolgen. Social-Media-Kanäle werden aufgebaut, Anzeigen geschaltet oder Inhalte produziert – oft ohne klare Zielsetzung oder langfristige Planung. Das Ergebnis: hohe Aufwände bei begrenzter Wirkung.

Die Württemberger Medien Agentur verfolgt bewusst einen anderen Ansatz. Im Mittelpunkt steht zunächst die Analyse. Bevor Maßnahmen umgesetzt werden, geht es darum, das Unternehmen, die Zielgruppe und den Markt genau zu verstehen.

Dazu gehören unter anderem:

- die Definition klarer Ziele und Zielgruppen

- die Analyse bestehender Marketingaktivitäten

- die Bewertung von Wettbewerbern und Marktposition

- die Identifikation von Potenzialen und Schwachstellen

Auf dieser Grundlage entsteht eine individuelle Strategie, die nicht nur kurzfristige Erfolge ermöglicht, sondern langfristig trägt.

Datenbasierte Entscheidungen statt Bauchgefühl

Ein wesentlicher Unterschied moderner Online-Marketing-Ansätze liegt in der Nutzung von Daten. Während Marketing früher oft stark von Erfahrung und Intuition geprägt war, stehen heute umfangreiche Analysemöglichkeiten zur Verfügung.

Die Württemberger Medien Agentur nutzt diese Möglichkeiten gezielt, um fundierte Entscheidungen zu treffen. Daten werden nicht nur gesammelt, sondern interpretiert und in konkrete Maßnahmen übersetzt. Dadurch lassen sich Maßnahmen kontinuierlich optimieren und Budgets effizient einsetzen.

Diese Arbeitsweise bringt mehrere Vorteile mit sich:

- bessere Planbarkeit von Marketingmaßnahmen

- transparente Erfolgsmessung

- gezielte Optimierung einzelner Kanäle

- langfristige Skalierbarkeit von Strategien

Gerade für wachsende Unternehmen ist diese Transparenz ein entscheidender Faktor.

Ganzheitlicher Blick auf digitale Kanäle

Online-Marketing besteht heute aus einer Vielzahl unterschiedlicher Disziplinen. Suchmaschinenoptimierung, Performance Marketing, Content-Strategie und Social Media greifen ineinander und beeinflussen sich gegenseitig.

Die Württemberger Medien Agentur betrachtet diese Bereiche nicht isoliert, sondern als Teil eines Gesamtsystems. Ziel ist es, die einzelnen Kanäle sinnvoll miteinander zu verknüpfen und so eine konsistente Markenkommunikation zu schaffen.

Dabei werden unter anderem folgende Bereiche integriert:

- Suchmaschinenoptimierung (SEO) für nachhaltige Sichtbarkeit

- Webdesign und Website-Entwicklung für einen professionellen digitalen Auftritt

- Digitale Mitarbeitergewinnung über zielgerichtete Online-Kampagnen

- Ganzheitliche strategische Beratung zur digitalen Sichtbarkeit und Kundengewinnung

Durch diese Verzahnung entsteht ein Marketingansatz, der sowohl kurzfristige Ergebnisse als auch langfristige Wirkung ermöglicht.

Fokus auf messbare Ergebnisse

Ein zentraler Anspruch der Württemberger Medien ist die Messbarkeit von Erfolg. Marketing wird nicht als kreativer Selbstzweck verstanden, sondern als strategisches Instrument zur Erreichung konkreter Unternehmensziele.

Das bedeutet, dass jede Maßnahme klar definierten Kennzahlen zugeordnet wird. Ob Traffic, Conversion-Rate oder Umsatz – die Ergebnisse werden kontinuierlich überprüft und ausgewertet.

Diese Transparenz schafft Vertrauen und ermöglicht es Kunden, ihre Investitionen nachvollziehbar zu steuern. Gleichzeitig bildet sie die Grundlage für eine kontinuierliche Weiterentwicklung der Strategie.

Zusammenarbeit auf Augenhöhe

Neben fachlicher Expertise spielt auch die Zusammenarbeit eine entscheidende Rolle. Die Württemberger Medien Agentur versteht sich nicht als externer Dienstleister im klassischen Sinne, sondern als strategischer Partner.

Das zeigt sich vor allem in der Kommunikation. Projekte werden eng mit den Kunden abgestimmt, Entscheidungen transparent getroffen und Entwicklungen regelmäßig besprochen. Ziel ist es, gemeinsam Lösungen zu entwickeln, die zum jeweiligen Unternehmen passen.

Diese partnerschaftliche Herangehensweise bringt mehrere Vorteile:

- klare Abstimmung von Zielen und Erwartungen

- schnelle Anpassung an Veränderungen

- langfristige Zusammenarbeit statt kurzfristiger Projekte

- bessere Integration in bestehende Unternehmensstrukturen

Gerade in dynamischen Märkten ist diese Flexibilität ein wichtiger Erfolgsfaktor.

Anpassungsfähigkeit in einem dynamischen Umfeld

Die digitale Welt verändert sich kontinuierlich. Neue Plattformen entstehen, Algorithmen werden angepasst und Nutzerverhalten entwickelt sich weiter. Für Unternehmen bedeutet das, dass Strategien regelmäßig überprüft und angepasst werden müssen.

Die Württemberger Medien Agentur begegnet dieser Dynamik mit einem flexiblen Ansatz. Statt starrer Konzepte setzt sie auf kontinuierliche Optimierung und Anpassung. Entwicklungen werden frühzeitig erkannt und in die Strategie integriert.

Dadurch bleiben Kunden nicht nur wettbewerbsfähig, sondern können neue Chancen aktiv nutzen.

Branchenübergreifende Erfahrung

Ein weiterer Vorteil der Württemberger Medien Online Marketing Agentur liegt in ihrer branchenübergreifenden Erfahrung. Zu den Kunden des Unternehmens zählen lokale und regionale Dienstleister, Handwerks- und Gewerbebetriebe sowie Unternehmen aus dem Mittelstand. Dadurch entsteht ein breites Verständnis für verschiedene Geschäftsmodelle, Zielgruppen und Marktmechaniken.

Diese Vielfalt hilft dabei, funktionierende Strategien nicht isoliert zu betrachten, sondern sinnvoll auf andere Bereiche zu übertragen. Was bei einem Dienstleistungsunternehmen zu mehr Sichtbarkeit und Anfragen führt, kann, richtig angepasst, auch für Handwerks- und Gewerbebetriebe sehr gut funktionieren. Gleichzeitig entstehen durch diese Perspektivwechsel oft innovative Ansätze, die über klassische Lösungen hinausgehen.

Dennoch bleibt jede Strategie individuell. Die Württemberger Medien Agentur setzt nicht auf standardisierte Konzepte, sondern passt Maßnahmen präzise an die jeweiligen Anforderungen an. Marktumfeld, Wettbewerbssituation und Zielgruppe werden dabei ebenso berücksichtigt wie interne Strukturen und Ressourcen des Kunden.

So entsteht ein ausgewogenes Verhältnis zwischen Erfahrung und Individualität – eine Kombination, die es ermöglicht, sowohl effizient als auch kreativ zu arbeiten und nachhaltige Ergebnisse zu erzielen.

Nachhaltiges Wachstum statt kurzfristiger Erfolge

Im Zentrum der Arbeit steht ein klares Ziel: nachhaltiges Wachstum. Während viele Marketingmaßnahmen auf schnelle Ergebnisse ausgerichtet sind, verfolgt die Württemberger Medien Agentur einen langfristigen Ansatz. Es geht nicht darum, kurzfristig Aufmerksamkeit zu erzeugen, sondern darum, stabile Strukturen aufzubauen, die dauerhaft funktionieren.

Das bedeutet, dass nicht nur einzelne Kampagnen optimiert werden, sondern das gesamte digitale Fundament eines Unternehmens gestärkt wird. Sichtbarkeit in Suchmaschinen, eine klare Markenpositionierung und eine gezielte Kundenansprache werden Schritt für Schritt aufgebaut und kontinuierlich weiterentwickelt.

Dabei spielen mehrere Faktoren zusammen. Eine technisch optimierte Website sorgt für eine bessere Auffindbarkeit, ein professioneller Markenauftritt stärkt die Außenwirkung und datenbasierte Kampagnen bringen gezielt Reichweite. Durch diese Kombination entsteht ein System, das nicht von einzelnen Maßnahmen abhängig ist, sondern als Ganzes wirkt.

Ein weiterer Vorteil dieses Ansatzes liegt in der Planbarkeit. Unternehmen erhalten eine klare Perspektive, wie sich ihre Marketingaktivitäten entwickeln und welche Ergebnisse realistisch zu erwarten sind. Gleichzeitig bleibt genügend Flexibilität, um auf Veränderungen im Markt zu reagieren und neue Chancen zu nutzen.

Dieser Fokus auf langfristige Entwicklung sorgt dafür, dass Unternehmen nicht nur kurzfristig wachsen, sondern sich nachhaltig im Wettbewerb positionieren können.

Fazit

Die Anforderungen an modernes Online-Marketing sind heute komplexer denn je. Unternehmen müssen sich in einem dynamischen Umfeld behaupten, ihre Zielgruppen verstehen und gleichzeitig effizient arbeiten. Gleichzeitig steigt der Druck, Marketingmaßnahmen nicht nur umzusetzen, sondern auch deren Wirkung nachvollziehbar zu machen.

Die Württemberger Medien Marketing Agentur zeigt, wie sich diese Herausforderungen strukturiert und zielgerichtet angehen lassen. Durch die Kombination aus datenbasierter Analyse, strategischer Planung und kontinuierlicher Optimierung entstehen Lösungen, die messbare Ergebnisse liefern und gleichzeitig langfristig tragen.

Besonders hervorzuheben ist der ganzheitliche Ansatz. Statt isolierter Maßnahmen entwickelt die Agentur ein umfassendes System, in dem alle digitalen Kanäle sinnvoll miteinander verknüpft sind. Dadurch wird nicht nur kurzfristige Sichtbarkeit erzeugt, sondern eine stabile Grundlage für nachhaltiges Wachstum geschaffen.

Für Unternehmen, die ihre digitale Präsenz gezielt ausbauen und langfristig stärken möchten, bietet dieser Ansatz eine klare Orientierung. Er verbindet Strategie, Technologie und Kommunikation zu einem durchdachten Gesamtbild – und schafft damit die Voraussetzungen für kontinuierlichen Erfolg in einem sich ständig verändernden Marktumfeld.

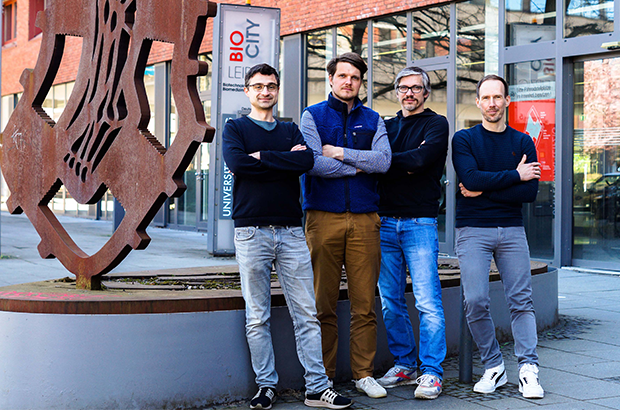

ESTER Biotech: Vom Friedhofskompost zur Plastik-Revolution

Ein Enzym vom Leipziger Südfriedhof soll das weltweite Plastikproblem lösen. Das 2025 als Uni-Spin-off gegründete Start-up ESTER Biotech verspricht, schwer recycelbares PET in Rekordzeit in seine Grundbausteine zu zerlegen. Doch auf dem Weg vom Labor in die industrielle Skalierung warten das berüchtigte „Valley of Death“ – und ein scheinbar übermächtiger Konkurrent.

Der Ursprung einer potenziellen industriellen Revolution liegt ausgerechnet auf einem Komposthaufen des Leipziger Südfriedhofs. Hier suchten Forschende der Universität Leipzig gezielt nach Mikroorganismen zur Zersetzung pflanzlicher Biopolymere und stießen auf das Enzym PHL7. Was in vielbeachteten Publikationen begann, mündete im Frühjahr 2025 in der offiziellen Ausgründung der ESTER Biotech GmbH.

Das Gründer-Quartett um die Geschäftsführer Dr. Ronny Frank und Martin Hirschfeld, den wissenschaftlichen Kopf Dr. Christian Sonnendecker (der das Enzym maßgeblich mitentdeckte) sowie den verfahrenstechnischen Leiter Madalin Ceausescu hat ein klares Ziel: das chemisch-biologische Recycling von Kunststoffen auf ein neues Level zu heben. Möglich machte diesen Schritt eine millionenschwere exist-Forschungstransfer-Förderung.

Für klassische Investor*innen sei die frühe Laborphase technologisch meist noch zu riskant, erklärt Christian Sonnendecker. Genau hier setzte das Programm an: „Der exist-Forschungstransfer hat für uns die Lücke zwischen akademischem Proof-of-Concept und einem investierbaren DeepTech-Start-up geschlossen“, betont der Gründer. „Wir konnten den Recyclingprozess vom Labormaßstab von einem Liter auf 100 Liter skalieren, neue Konzepte realisieren und das Verfahren validieren.“

Was passiert im Bioreaktor mit schmutzigem Müll?

Das technologische Versprechen ist enorm: Das modifizierte Enzym zerlegt selbst schwer recycelbares PET – wie Multilayer-Verpackungen – bei moderaten 65 Grad Celsius und Reaktionszeiten von unter 6 Stunden. Daraus kann neuwertiges, lebensmittelechtes Plastik entstehen. Doch wie reagiert das System in der Realität auf stark kontaminierten Haushaltsmüll? „Wir haben bislang keinen echten Show-Stopper gesehen“, sagt Sonnendecker pragmatisch. Er verzichtet auf romantische Labor-Illusionen und ordnet die Fakten nüchtern ein: „Enzyme gelten als empfindlich, aber in der Praxis arbeiten sie erstaunlich resilient. In den typischen Abfallfraktionen, die wir getestet haben, führen Störstoffe aus Haushaltsverpackungen nicht zu kritischen Aktivitätsverlusten.“

Der tatsächliche Flaschenhals sei nicht die Biologie, sondern die Wirtschaftlichkeit: „Je stärker eine Abfallfraktion kontaminiert ist, desto geringer die Ausbeuten, begleitet mit höherem Aufwand bei Aufarbeitung und Reinigung der Produkte. Das erhöht die Kosten.“

Ein patentierter Moat – mehr als nur ein KI-Hype

Um die Enzyme rasant an neue Herausforderungen anzupassen, nutzt ESTER eine patentierte, KI-gestützte Screening-Technologie. Ist das ein echter Schutzwall gegen gut finanzierte BioTech-Labore in Asien oder den USA? Sonnendecker relativiert den reinen Algorithmus-Hype mit einem treffenden Vergleich: „KI ist heute kein exklusives Werkzeug mehr. Als Schreiben zugänglich wurde, bedeutete das nicht, dass plötzlich jeder ein guter Autor war.“

Der wahre Moat („Burggraben“) liege vielmehr in der eigenen Hardware und der Datenqualität: „Unser patentierter Ansatz basiert auf einer Messmethode, die den Kunststoff mittels Elektrizität selbst beobachtet. Dadurch erhalten wir multiparametrische und hochqualitative Daten. Der eigentliche Moat entsteht deshalb nicht durch ein einzelnes ‚Superenzym‘, sondern durch die integrierte Plattform und den Blick auf das Große.“

Regulatorik als Treiber

Der globale Markt für recyceltes PET (rPET) wird aktuell auf rund 5 Millionen Tonnen beziffert. Angetrieben wird das Wachstum durch strenge EU-Vorgaben (PPWR), die ab 2026 greifen und das Ende des billigen Neu-Plastiks einläuten. Aber was passiert, wenn Plastik aus Erdöl politisch geduldet und weiterhin deutlich billiger bleibt? „Natürlich ist Neu-Plastik aus Erdöl in vielen Fällen günstiger“, räumt Sonnendecker ein. „Aber dieser Preisvorteil basiert auf einer von fossilen Ressourcen abhängigen, linearen Wertschöpfungskette – also einer Sackgasse.“

Deutlicher wird der Gründer beim Blick auf die Konkurrenz. Der französische Marktführer Carbios bindet bereits Giganten wie L'Oréal oder Nestlé an sich. Droht ESTER den Anschluss zu verlieren? „Wir beäugen die Entwicklung von Carbios mit Skepsis“, teilt Sonnendecker selbstbewusst aus.

Tatsächlich geriet der Branchenprimus zuletzt ins Straucheln: Anfang 2025 kündigte Carbios einen drastischen Stellenabbau an, der Bau der ersten industriellen Anlage im französischen Longlaville musste aus Finanzierungsgründen auf 2028 verschoben werden. Stattdessen fokussieren sich die Franzosen nun auf ein Joint Venture mit dem chinesischen PET-Hersteller Wankai, um ab 2026 eine Anlage in Asien hochzuziehen.

Für Sonnendecker ein klares strategisches Warnsignal: „Wir sehen hier die Gefahr, dass europäische Technologie abwandert und genau jene industrielle Resilienz in Europa nicht entsteht, die so wichtig für unsere Unabhängigkeit wäre.“ Der Mitgründer ergänzt: „Weiterhin geht uns Carbios nicht weit genug, denn die Technologie bietet noch viel mehr. Wir konzentrieren uns gezielt auf bislang nicht verwertbare PET-Ströme, die heute in der Verbrennung landen und wollen in Synergie mit mechanischen Recyclern gehen. Und dabei ist PET nur der Anfang: Unser Ziel ist es, aktiv die Kunststoffwelt von morgen mitzugestalten, indem wir unsere Technologien bei der Entwicklung neuer Kunststoffe nach dem Prinzip Design for Circularity ins Spiel bringen. Wir setzen dabei auf die Werkzeuge der Natur, Enzyme, um zukunftsfähige Lösungen skalierbar zu machen und der nächsten Generation von Kunststoffen den Weg in den Markt zu ebnen.“

Die unweigerliche Millionenfrage

ESTER positioniert sich als Angreifer, doch im Jahr 2026 beginnt die kritische Phase. Der Sprung in den industriellen Dauerbetrieb ist in der Biotechnologie historisch extrem kapitalintensiv – das klassische „Valley of Death“. Da die öffentlichen Fördermittel auslaufen, sind nun echte Venture-Capital-Millionen gefragt. Wie will das Start-up überleben, ohne direkt die Mehrheit an Großinvestor*innen abgeben zu müssen?

„Für uns ist entscheidend, nicht in die klassische Falle zu laufen, alles auf eine kapitalintensive eigene Anlage zu setzen“, erklärt der Gründer seine Strategie. Demonstrations- und Pilotanlagen würden lieber angemietet statt selbst gebaut. „Das reduziert den Kapitalbedarf in dieser kritischen Phase erheblich.“ Für die anstehenden Verhandlungen mit großen VC-Fonds zeigt er sich kompromisslos: „Wir kommen nicht aus einer Position des Zwangs, sondern mit validierter Technologie, ersten Umsätzen, starken Partnern und klaren Skalierungspfaden.“

Schluss mit Swipen: Wie vibe deep aus Dating-Frust ein Relationship-Business machen will

Dating-Apps frustrieren, die Einsamkeit wächst. Das Hamburger Start-up vibe deep setzt daher auf „Deep Talk“ statt Swiping. Eine Analyse des neuen Geschäftsmodells, das beweisen will, dass sich mit emotionaler Tiefe ein skalierbares Tech-Unternehmen aufbauen lässt.

Die makroökonomischen und gesellschaftlichen Vorzeichen für eine Neuausrichtung digitaler sozialer Dienste sind eindeutig. Weltweit gilt laut der Weltgesundheitsorganisation (WHO) mittlerweile jede sechste Person als einsam. Allein in Deutschland geben über 42 Prozent der Bevölkerung an, in regelmäßigen Abständen Einsamkeit zu verspüren. Gleichzeitig zeigen klassische, auf raschen Konsum ausgelegte Dating-Apps massive Ermüdungserscheinungen. Die aktiven Nutzer*innenzahlen von Branchengrößen wie Tinder, Bumble und Hinge fielen im vierten Quartal 2024 global um sechs Prozent. Rund 69 Prozent aller heruntergeladenen Dating-Apps werden bereits innerhalb eines Monats wieder gelöscht.

Vor allem die junge Zielgruppe zieht Konsequenzen: Im Jahr 2024 planten 63 Prozent der Generation Z einen bewussten „Social-Media-Detox“ – mehr als jede andere Generation. Der Markt verlangt ganz offensichtlich nach echter Verbindung statt nach oberflächlichem, medialem Dopamin, welches das Fehlen realer Nähe oftmals nur vernebelt.

Genau in diese Lücke der wachsenden Dating-Ermüdung stößt die App vibe deep, mit der das Hamburger Start-up von Lui und Saskia Michalski den Fokus konsequent auf Deep Talk statt Swiping verschiebt.

Vom Content zum Tech-Produkt

Dabei war der Weg zum Tech-Unternehmen für die Gründer*innen, die zunächst als Content-Creator*innen im Bereich nicht-monogamer Lebensweisen erfolgreich wurden, keine klassische Laufbahn. Doch der Schritt in die Tech-Branche war eine logische Konsequenz aus dem wachsenden Frust ihrer Community. „Der Schlüsselmoment war eigentlich ein schleichender“, erinnert sich Saskia. Jahrelang hätten sie fehlende Tiefe und Einsamkeit thematisiert, doch die Probleme der Menschen seien eher gewachsen als geschrumpft. „Content allein bringt Menschen nicht ins Handeln“, konstatiert Saskia. „Er schafft Bewusstsein, aber keine echte Veränderung.“ Daraus sei der Entschluss gereift, ein Werkzeug zu bauen, das konkrete Interaktion ermöglicht.

Lui ergänzt: „Genau daraus ist vibe deep entstanden: als Produkt, nicht als Content-Verlängerung.“ Um das Vorhaben umzusetzen, übernahm er dank seines Hintergrunds in der Tech-Industrie das Product Management. Unterstützt werden die beiden von einem externen CTO, der die Entwicklung mit einem internationalen Team vorantreibt. Doch die Technik sei nur die halbe Miete: „Die eigentliche Innovation liegt nicht nur in der Technologie, sondern im Verständnis von Beziehungen – und genau das bringen wir als Gründer*innen mit“, betont Lui.

Deep Talk statt Dauerkonsum

Im Gegensatz zu bestehenden Plattformen, die auf die Quantität neuer Kontakte ausgelegt sind, setzt vibe deep auf die Intensivierung bereits bestehender Beziehungen. Der Mechanismus ist simpel, aber wirkungsvoll: Die App liefert den Nutzenden individuell angepasste Anregungen und stellt tiefgreifende psychologische Fragen – etwa zum persönlichen Umgang mit Konflikten. Der entscheidende Clou zur Steigerung des Engagements liegt darin, dass die Antworten erst ersichtlich werden, wenn alle beteiligten Parteien sich mit ihren eigenen Erwartungen auseinandergesetzt und diese in der App beantwortet haben.

Flankiert wird dieses Konzept von einer künstlichen Intelligenz, deren Nutzung jedoch streng an die Zustimmung aller Beteiligten geknüpft ist. Gerade beim Umgang mit hochsensiblen Paardaten stellt sich unweigerlich die Frage nach Datensicherheit. Auf Nachfrage versichert Lui strenge Standards: „Wir bauen kein Produkt, das ohne Vertrauen funktionieren kann.“ Er verweist auf Datensparsamkeit, pseudonymisierte Strukturen und die klare Regel, Inhalte nicht für das Training von KI-Modellen zu nutzen.

Saskia präzisiert den ethischen Rahmen der Technologie: Die KI sei darauf ausgelegt, „nicht zu bewerten oder Lösungen vorzugeben, sondern Verbindung zu fördern durch Spiegeln, Nachfragen und Perspektivwechsel“. Dabei bleiben die Algorithmen bewusst in einer unterstützenden, nicht-dominanten Rolle und greifen nur ein, wenn beide Partner*innen dies explizit wünschen. Den Kern ihres Anspruchs fasst Saskia pointiert zusammen: „Die intimsten Gespräche eines Menschen gehören nicht uns – wir dürfen nur den Raum dafür halten.“

Community-Power als Raketenstart im Haifischbecken

Mit über 600.000 Follower*innen über alle sozialen Netzwerke hinweg verfügt das Duo über eine immense organische Reichweite. Diese schlägt sich in den Startmetriken der App wider: In den ersten acht Wochen wurden bereits über 50.000 Fragen von den User*innen beidseitig beantwortet. Zudem verzeichnete die App in den ersten Wochen über 10.000 Installationen und konnte dabei mehr als 300 Premium-Aktivierungen vermerken.

Besonders bemerkenswert sind die emotionalen Erfolgsmetriken: Laut Unternehmensangaben bestätigen 75 Prozent der Nutzenden, dass sich ihr Verhältnis zueinander nach zehn Tagen signifikant verbessert hat. Ehrliche Kommunikation birgt jedoch auch Konsequenzen, denn laut denselben Daten endete jede zehnte Beziehung in diesem Zeitraum mit einer sofortigen Trennung.

Der Markt für „Relationship Care“ wächst und lockt international Wagniskapital an. Zu den Mitbewerbenden zählen das britische Start-up Paired sowie die US-amerikanischen Pendants Agapé und Coral. Im deutschsprachigen Raum konkurriert vibe deep unter anderem mit PAIRfect und recoupling, die durch TV-Show „Die Höhle der Löwen“ nationale Bekanntheit erlangten.

Doch wie grenzt man sich von diesen Millionen-Playern ab? „Viele der bestehenden Player bauen im Kern Therapie-Tools für romantische Zweierbeziehungen. Das bildet aber nur einen sehr kleinen Ausschnitt davon ab, was Beziehung eigentlich ist“, kritisiert Saskia Michalski. Vibe deep begreife Verbundenheit deutlich breiter – ob in Freundschaften, beim Dating oder in offenen Konstellationen. Tatsächlich nutze über die Hälfte der User*innen die App mit mehr als einer Person. „Deshalb bauen wir keine Therapie-App für Paare, sondern eine Infrastruktur für Verbindung“, resümiert Saskia.

Zwischen Viralität und Churn-Gefahr

Die Monetarisierung erfolgt derzeit über ein monatliches Abo-Modell, das dem Start-up verlässliche wiederkehrende Umsätze (MRR) sichern soll und tiefere Einblicke sowie mehr KI-Funktionen freischaltet. Für Lui war dieser erste Schritt ein erfolgreicher Test: „Die Frage war, ob Menschen grundsätzlich bereit sind, für tiefere Verbindung zu zahlen. Und die Antwort ist klar: Ja.“ Gleichzeitig räumt er ein, dass die App weniger als Daily-Produkt, sondern eher in intensiven emotionalen Peak-Phasen genutzt wird, weshalb man nun auch mit Wochen- und Jahres-Abos experimentiere. Finanziell agiert das Duo bislang völlig eigenständig („100% bootstrapped“), schließt aber externe Investor*innen für die nächste Wachstumsphase nicht aus. „In sechs Monaten können wir diese Frage also sicherlich schon deutlich präziser beantworten“, so Lui.

Das Geschäftsmodell ist ein klassisches Beispiel für die Monetarisierung innerhalb der Creator Economy. Durch die riesige Community bleiben die Akquisekosten extrem niedrig. Zudem erzeugt die Mechanik der zunächst verborgenen Antworten einen eingebauten Viral-Loop, der enorme Neugier weckt. Dennoch zeigen sich Skalierungsrisiken: Mit einer Conversion-Rate von rund drei Prozent muss vibe deep beweisen, dass es den Sprung aus der Influencer*innen-Blase in den Massenmarkt schafft.

Die größte Herausforderung bleibt das branchenbekannte „Churn-Paradoxon“: Löst die App ihr Versprechen ein und heilt die Beziehung – oder führt sie zur Trennung –, entfällt auf Dauer der primäre Use Case für die Endkonsument*innen.

Saskia widerspricht dieser Lesart jedoch energisch. Das Paradoxon basiere auf einem überholten Verständnis von Beziehungen, bei dem man ein Problem löst und dann „fertig“ sei. „Verbindung ist kein Zustand, den man einmal erreicht, sondern etwas, das sich ständig verändert“, analysiert Saskia. Weil die Nutzenden die App über mehrere Verbindungen und Lebensphasen hinweg nutzen, steige der Customer Lifetime Value ganz natürlich.

Perspektivisch plant das Start-up zudem Erweiterungen im B2B2C-Bereich, etwa als Begleit-Tool für Coaches und Paartherapeut*innen oder für das Team-Building in Unternehmen. Der Fokus bleibe vorerst jedoch auf den Endkonsument*innen. Saskia Michalski bringt die Vision selbstbewusst auf den Punkt: „Wir bauen kein Tool für ein Problem, das verschwindet, sondern für etwas, das immer wieder entsteht.“

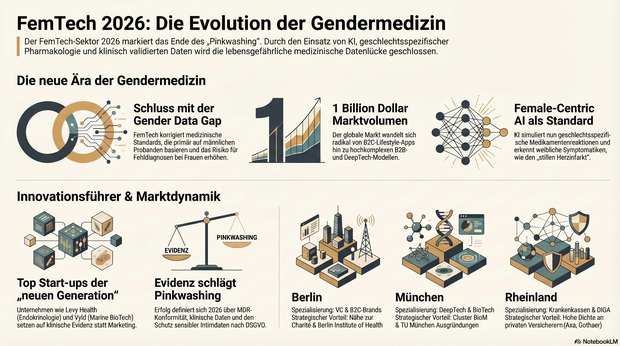

FemTech-Start-up-Report 2026

Schluss mit Pinkwashing! Wie deutsche FemTech-Start-ups 2026 die Gender Data Gap schließen und unser Gesundheitssystem neu codieren.

Lange Zeit belächelt, in eine rosarote Lifestyle-Ecke gedrängt und von männlich dominierten Investment-Komitees als Nischenthema abgetan: FemTech hat einen beispiellosen Reifeprozess hinter sich. Doch der eigentliche Paradigmenwechsel des Jahres 2026 findet tief in der Pharmakologie und der klinischen Forschung statt. Jahrzehntelang galt in der Medizin der 70 Kilogramm schwere Durchschnittsmann als universeller Standard. Die fatale Folge dieser sogenannten Gender Data Gap ist, dass Medikamente primär an männlichen Probanden getestet wurden, weshalb Frauen bis heute ein dramatisch höheres Risiko für Fehldiagnosen und schwere Nebenwirkungen tragen. Der weibliche Körper verstoffwechselt Wirkstoffe aufgrund hormoneller Zyklen und abweichender Enzymaktivitäten völlig anders. Vom einstigen Tabuthema zum DeepTech-Sektor beweist die Branche heute, dass geschlechtsspezifische Medizin kein Nischendasein mehr fristet, sondern ein systemkritisches Versäumnis korrigiert. FemTech schließt endlich diese lebensgefährliche Datenlücke und wird so zum unverzichtbaren Rückgrat einer gerechten, digitalen Medizin.

Datenpower gegen die medizinische Unsichtbarkeit

Der globale Markt für Frauengesundheit steuert laut aktuellen Analysen von McKinsey weltweit auf die Eine-Billion-Dollar-Marke zu. In Deutschland zeigt sich 2026 eine deutliche Konsolidierung. Während die Dealroom-Daten nach dem Hype der frühen 2020er Jahre zunächst eine Delle verzeichneten, hat sich das Investitionsvolumen in der DACH-Region mittlerweile auf einem konstant hohen Niveau stabilisiert. Laut einer Einschätzung der KfW fließen die Gelder heute jedoch smarter: Weg vom überfüllten B2C-Consumer-Markt, hin zu B2B-Modellen und DeepTech.

Der unangefochtene Haupttreiber in diesem Jahr ist die künstliche Intelligenz, die in der Diagnostik, bei der Mustererkennung von Biomarkern und vor allem in der Simulation geschlechtsspezifischer Medikamentenreaktionen neue Standards setzt. Series-A-Runden im zweistelligen Millionenbereich sind für wissenschaftlich validierte Geschäftsmodelle in Deutschland keine Seltenheit mehr, da die Erkenntnis gereift ist, dass eine Medizin, die die Hälfte der Menschheit ignoriert, schlichtweg ökonomisch ineffizient ist.

Gender-Pharmakologie und Female-Centric AI

Die FemTech-Welle der ersten Stunde wurde von Menstruations-Apps dominiert. Pioniere wie das Berliner Start-up Clue haben dafür den Weg bereitet. Doch 2026 dominieren völlig neue, hochkomplexe Sub-Sektoren das Feld. Erstens sehen wir einen massiven Push im Bereich der geschlechtsspezifischen Pharmakologie. Da der weibliche Metabolismus stark von Hormonzyklen beeinflusst wird, nutzen Start-ups heute synthetische Daten und KI, um virtuelle klinische Studien an weiblichen Profilen durchzuführen. Zweitens rückt die geschlechtsspezifische Kardiologie und Onkologie in den Fokus, bei der Algorithmen explizit auf weibliche Symptomatiken – wie den oft unerkannten „stillen Herzinfarkt“ bei Frauen – trainiert werden. Drittens boomt das Metabolische Biomonitoring, das präventiv Autoimmunerkrankungen trackt, die Frauen überproportional oft betreffen. Diese Entwicklung wird massiv durch Einrichtungen wie das Institut für Geschlechterforschung in der Medizin (GiM) an der Berliner Charité flankiert, das die klinische Gendermedizin maßgeblich vorantreibt.

Die Lektionen aus dem Crash der Lifestyle-Apps

Dass der Weg zur Profitabilität steinig ist, zeigte in der jüngeren Vergangenheit das spektakuläre Scheitern des US-Konzerns FemTec Health, der nach einer aggressiven Übernahmewelle – unter anderem des einstigen Schweizer Vorzeige-Start-ups Ava – grandios implodierte. Aus diesem Crash lassen sich für heutige Gründer*innen vier fatale Fallstricke ableiten. Der erste und wichtigste Fehler war die gnadenlose Unterschätzung der europäischen Medizinprodukteverordnung (MDR), die vielen Hardware-Produkten im Nachhinein das Genick brach. Zweitens offenbarten sich völlig zerstörte Unit Economics, da reine Direct-to-Consumer-Modelle durch exorbitante Marketingkosten unprofitabel wurden. Ein dritter Irrtum war das „Pinkwashing“: Es wurde mehr Budget in Lifestyle-Marketing gepumpt als in echte klinische Evidenz, was den Zugang zu essenziellen Krankenkassen-Erstattungen blockierte. Der vierte Fallstrick war die fehlende Spezialisierung auf Gender-Daten; Unternehmen, die lediglich eine weibliche Benutzeroberfläche für männliche Medizinstandards bauten, scheiterten am mangelnden medizinischen Mehrwert.

Wo die geschlechtsspezifische Innovation hierzulande pulsiert

Deutschlands FemTech-Landschaft konzentriert sich 2026 auf hochspezialisierte Hubs. Berlin bleibt der absolute Magnet für Venture Capital und B2C-Brands, stark befeuert durch die Nähe zur Charité und dem Berlin Institute of Health (BIH), das intensiv an der Schließung der Gender Data Gap arbeitet. München hat sich hingegen als das Epizentrum für DeepTech und BioTech etabliert, getragen von den exzellenten Ausgründungen der TU München und dem Cluster BioM. Ein oft unterschätzter, aber extrem relevanter Hotspot ist das Rheinland, insbesondere die Achse Köln/Bonn. Durch die hohe Dichte an privaten Krankenversicherern und Kooperationspartnern wie der Axa oder Gothaer ist dies der ideale Boden für Start-ups, die auf DiGA-Zulassungen schielen. Die Rhein-Neckar-Region um Heidelberg fungiert dank des Deutschen Krebsforschungszentrums (DKFZ) und dem Medizintechnologie-Cluster CUBEX in Mannheim als entscheidende Brücke zwischen harter Onkologie und frauenspezifischer Gesundheitsforschung.

Investor*innen-Radar

Die Investor*innenlandschaft hat sich massiv ausdifferenziert und gleicht 2026 einem hochprofessionellen Ökosystem. Auf der ersten Ebene agieren spezialisierte VCs wie der Auxxo Female Catalyst Fund oder Calm/Storm Ventures, die den Markt mit tiefer Expertise treiben. Die zweite Ebene bilden die Top-Tier Generalisten: Adressen wie Cherry Ventures, HV Capital und der spezialisierte Ableger Earlybird Health haben den ROI von FemTech längst erkannt. Drittens greifen Corporate VCs der Industrie massiv ein; hier positionieren sich Einheiten wie Bayer G4A oder der Roche Venture Fund frühzeitig, um sich strategische Innovationen im Diagnostikbereich zu sichern. Das Fundament bilden hochaktive Business Angels wie Gloria Bäuerlein, Gesa Miczaika und Startup-Verbands-Präsidentin Verena Pausder, die mit ihren Investments echte Signalwirkung erzeugen, während Syndikate wie encourageventures entscheidende Brücken in den Pre-Seed-Phasen bauen.

Die Top Start-ups (Must-Watch)

Für die folgende Auswahl der Top Start-ups des Jahres 2026 haben wir strenge Kriterien angelegt. Im Fokus stehen ausschließlich in Deutschland ansässige Unternehmen der „neuen Generation“ mit einem Gründungsjahr ab 2020. Wir bewerten die Marktrelevanz im Kontext der Gender-Medizin, den technologischen Reifegrad, das Vertrauen namhafter Lead-Investor*innen sowie die Fähigkeit, echte medizinische Datenlücken zu schließen. Die Redaktion hat diese Auswahl unabhängig und ohne finanzielle Gegenleistungen getroffen.

Levy Health (Gründung: 2021)

Das in Berlin gegründete Trio Caroline Mitterdorfer, Priv.-Doz. Dr. med. Theresa Vilsmaier und Silvia Hecher adressiert die komplexe Welt der Endokrinologie. Ihr B2B-SaaS-Produkt ist eine CE-zertifizierte Software zur klinischen Entscheidungsunterstützung, die Mediziner*innen hilft, die wahren Ursachen für weibliche Unfruchtbarkeit schneller zu entschlüsseln. Statt nur hormonelle Daten aufzubereiten, analysiert der Algorithmus umfassende klinische Parameter und Laborwerte, um eine massive diagnostische Lücke in der Reproduktionsmedizin zu schließen. Wie enorm das Skalierungspotenzial dieser Technologie ist, zeigte sich bei einer Seed-Runde über 4,5 Millionen US-Dollar: Angeführt vom US-Fonds XYZ Venture Capital und begleitet von Atlantic Labs, nutzte Levy Health das Kapital, um seinen Hauptsitz strategisch nach San Francisco zu verlegen – während Berlin die entscheidende europäische Entwicklungsbasis bleibt

Ovom Care (Gründung: 2023)

Felicia von Reden, die Gynäkologin Dr. Lynae Brayboy und die renommierte Embryologin Dr. Cristina Hickman heben die Reproduktionsmedizin mit Ovom Care auf ein neues Level. Das als Spin-off des Berliner KI-Studios Merantix gestartete Unternehmen verbindet reale physische Kinderwunschzentren – mit ersten Klinik-Standorten in Lissabon und Großbritannien – mit einer hochkomplexen Software zur Therapieplanung. Der USP: Der Algorithmus nutzt globale Patientinnendaten, um IVF-Behandlungen präzise auf den individuellen weiblichen Körper zuzuschneiden. Für diese technologische Schließung der Datenlücke sammelte das Start-up in einer Seed-Runde 4,8 Millionen Euro ein, angeführt vom Deep-Tech-VC Alpha Intelligence Capital (AIC) unter strategischer Beteiligung von Merantix und Ananda Impact Ventures.

Endo Health (Gründung: 2020)

Die Gynäkologin Dr. med. Nadine Rohloff und der Wirtschaftsinformatiker Markus Rothenhöfer (CIO) haben mit der in Chemnitz ansässigen Endo Health GmbH ein Unternehmen geschaffen, das sich lange Zeit exklusiv der Krankheit Endometriose widmete. Das Ursprungsmodell basiert auf der Endo-App, einer digitalen Gesundheitsanwendung (DiGA), die offiziell vom BfArM gelistet ist und auf Kassenkosten verschrieben werden kann. Im Jahr 2025 vollzog das Start-up jedoch den strategischen Sprung zur Multi-Disease-Plattform und launchte mit „Paula“ eine innovative App-Lösung für Betroffene des Polyzystischen Ovarialsyndroms (PCOS). Dieses enorme technologische Skalierungspotenzial für chronische Frauenkrankheiten überzeugte Geldgeber: Zu den Investoren der jüngsten Expansionsrunden zählen unter anderem Atreyu Investments, Cimexia GmbH, der Berlin Angel Fund und IBB Ventures.

Femfeel (Gründung: 2020)

Das Gründungstrio Janna Kraft, Marie Reger und Michaela Lehr widmet sich mit Femfeel der weiblichen Lebensmitte und überführt die Menopause in die digitale Versorgung. Ihr smartes B2B2C-Modell umgeht langwierige Rezept-Prozesse: Femfeel kombiniert App-basierte Begleitung mit evidenzbasierten Lebensstil-Interventionen, die offiziell als Präventionskurse (nach § 20 SGB V) zertifiziert sind und somit direkt von den Krankenkassen erstattet werden. Wie enorm wertvoll dieser präventive Markt geworden ist, bewies Femfeel durch einen hochbeachteten Exit: Das Start-up wurde von der Medice Health Family – einem Schwergewicht des deutschen Pharma-Mittelstands – übernommen und in dessen Digital-Health-Sparte integriert. Ein historisches Paradebeispiel dafür, wie stark die etablierte Industrie aktuell im FemTech-Sektor konsolidiert.

Frieda (Gründung: 2020)

Valentina Ullrich, Dr. med. Kai Schulze-Wundling und Thanh Schrader-Nguyen adressieren mit Frieda die Gendermedizin in der Menopause und gehen dabei tief in die klinische Diagnostik. Ursprünglich unter dem Namen Loba Health gestartet, agiert das Unternehmen heute als hybride digitale Klinik. Der USP: Statt den Östrogenabfall als Lifestyle-Thema abzutun, kombiniert Frieda datengestützte Telemedizin mit digitaler kognitiver Verhaltenstherapie (CBT) für eine evidenzbasierte Behandlung. Die Menopause wird hier als diagnostisches Fenster begriffen, um Gesundheitsdaten zur aktiven Prävention von altersbedingten Folgekrankheiten (wie Osteoporose) zu nutzen. Dieser konsequente Ansatz überzeugte auch den Schweizer Company Builder Maximon, der diese Brücke zur Langlebigkeit (Longevity) mit einem Seed-Investment von 2,5 Millionen Euro untermauerte.

Vyld (Gründung: 2021)

Ines Schiller und Melanie Schichan transformieren mit Vyld die Monatshygiene durch marine Biotechnologie. Das Start-up bietet sogenannte Kelpons aus Meeresalgen an. Dieser Rohstoff ist nicht nur radikal nachhaltig, sondern liefert einen massiven medizinischen USP: Algen sind von Natur aus hypoallergen, extrem saugfähig und kommen ohne schädliche Bleichmittel oder PFAS (Ewigkeitschemikalien) aus, was das empfindliche vaginale Mikrobiom aktiv schützt. Radikal ist bei Vyld auch die Struktur: Das Start-up agiert im Verantwortungseigentum (Steward-Ownership), wodurch Unternehmenszweck und Sicherheit stets vor kurzfristiger Gewinnmaximierung der Gesellschafter stehen. Dass dieser ethische DeepTech-Ansatz massiv skalieren kann, beweist die Finanzierung: Neben Impact-Investoren wie The Case for Her und millionenschweren Crowdinvesting-Instrumenten wird die Materialforschung von Vyld durch signifikante Fördermittel des Bundesministeriums für Bildung und Forschung (BMBF) validiert.

theblood (Gründung: 2022)

Das Gründerinnen-Duo Isabelle Guenou und Miriam Santer nutzt Menstruationsblut als diagnostische Goldmine. Ihr Geschäftsmodell basiert auf einer innovativen, nicht-invasiven Analyseplattform, die das lange tabuisierte Menstruationsblut nutzt, um ein breites Spektrum an Biomarkern – von Sexualhormonen bis hin zu essenziellen Nährstoffen wie Ferritin (Eisen) – zu tracken. Ein natürliches, zyklisches Abfallprodukt wird so zum hochwertigen Datensatz für die präventive Gesundheitsvorsorge, ganz ohne Nadelstich beim Arzt. Wie resilient und marktreif das Duo agiert, bewies es nach einem medienwirksam geplatzten TV-Investment („Die Höhle der Löwen“): theblood ließ sich nicht beirren und holte stattdessen hochkarätige strategische Partner an Bord. Dass dieser Ansatz massives Vertrauen genießt, zeigt die heutige Riege der Geldgeber: Neben Roosh Ventures und RoX Health investierte unter anderem Klosterfrau Ventures strategisch in die Berliner Pionierarbeit.

Internationaler Ausblick & Fazit

Der Blick über die deutschen Grenzen zeigt 2026 klar, in welche Richtung der Kompass navigiert. Aus den USA schwappt eine massive Welle der KI-basierten Wirkstoffentdeckung speziell für gynäkologische Erkrankungen nach Europa, während Asien die Hardware-Miniaturisierung für kontinuierliches Hormon-Tracking vorantreibt. Ein entscheidender globaler Makro-Trend ist jedoch die Souveränität der Intimdaten. In einer volatilen regulatorischen Ära in den USA (Post-Roe-v.-Wade) hat sich die europäische DSGVO vom Standortnachteil zum ultimativen Wettbewerbsvorteil entwickelt. Internationale Nutzerinnen suchen zunehmend Schutz bei europäischen Plattformen, die strikte Datensicherheit garantieren. Dies eröffnet deutschen Start-ups ungeahnte Exportchancen als absolute Vertrauensführer.

Für Gründer*innen und Investor*innen bedeutet dies: Die Zeit der reinen Wellness-Gadgets ist endgültig vorbei. Wer 2026 erfolgreich sein will, muss die Gender Data Gap schließen, klinische Evidenz liefern und den Datenschutz als ethisches Fundament begreifen. FemTech ist kein Nischen-Portfolio-Baustein mehr für die Diversity-Quote, sondern der am stärksten unterbewertete Treiber für die Zukunft der gesamten Gesundheitsökonomie. Wer heute in Gender-Medizin investiert, investiert in die Qualität der Medizin von morgen.

ODONATAs Sprung zur Multi-Mission-Drohne

Vom scheiternden Lufttaxi-Traum zum taktischen Technologieträger: Das Münchner Start-up ODONATA hat mit dem PANTALA-Hovertest einen entscheidenden Pivot eingeleitet. Am 10. April 2026 erreichte das Unternehmen auf dem Militärflughafen der Bundeswehr im fränkischen Roth einen Meilenstein und absolvierte den ersten Schwebeflug des 1:1-Prototyps seiner Langstreckendrohne. Doch hinter der Erfolgsmeldung steckt eine tiefgreifende strategische Neuausrichtung des 2021 von Dennis Furchheim, Tobias Nickel und Dominik Weigl gegründeten Unternehmens. Wir haben uns mit Co-Founder Dennis Furchheim darüber ausgetauscht.

Gegründet im Jahr 2021 im Rahmen des ESA-Business-Incubation-Programms, verfolgten die ODONATA-Gründer Dennis Furchheim, Tobias Nickel und Dominik Weigl ursprünglich eine weitaus kapitalintensivere Vision: ein bemanntes, wasserstoffbasiertes Flugtaxi (eVTOL). Doch die Realität der Finanzmärkte zwang das Team zum Umdenken. „Die Finanzierung eines solchen Vorhabens ist grundsätzlich schon nicht einfach“, erinnert sich CEO Dennis Furchheim an die kritischen Phasen der letzten fünf Jahre.

Besonders die Probleme anderer Branchengrößen belasteten das junge Unternehmen: „Wenn aber die Entwicklungen, wie beispielsweise bei Lilium, einen in Sippenhaft nehmen, weil nicht unterschieden wird zwischen verschiedenen Konzepten, dann wird es noch härter.“ In dieser Situation habe der „Zeitenwechsel“ und der neue Fokus auf Dual-Use den nötigen Befreiungsschlag ermöglicht.

Mitte 2024 folgte der scharfe Kurswechsel weg vom zertifizierungsrechtlich komplexen Passagiermarkt. Furchheim räumt offen ein, dass dies auch eine Reaktion auf den Standort Deutschland war: „Wir haben ursprünglich mit dem Ziel gestartet, ein eVTOL für Passagiere zu entwickeln und zu produzieren. Wir haben allerdings lernen müssen, dass Investoren in Deutschland nicht in so langfristig angelegte Projekte investieren.“

Der Schwenk zur autonomen Drohne PANTALA sei zwar „hart“ gewesen, doch das Team konnte wertvolle Erfahrungen und Technologien aus der ersten Phase transferieren.

PANTALA: Technik mit Schwerpunkt-Trick

Die nun getestete PANTALA-Drohne ist als Multi-Mission-Plattform konzipiert, die Logistik, Lagebildgewinnung und Drohnenabwehr vereint. Mit einer Spannweite von 7,9 Metern und einem maximalen Startgewicht von 280 Kilogramm kann sie bis zu 80 Kilogramm Nutzlast transportieren. Dank einer hybriden Antriebsarchitektur – batterieelektrisch für Start und Landung, ein Kraftstoffsystem für den Reiseflug – soll sie über zehn Stunden in der Luft bleiben und eine Reichweite von mehr als 1.100 Kilometern erzielen.

Ein technologisches Highlight ist der zum Patent angemeldete verschiebbare Antriebsstrang, der die Schwerpunktsanpassung im Flug bei variierenden Lasten ermöglicht. Angesprochen auf die Zukunftsfähigkeit des Antriebs gibt sich der Gründer pragmatisch. „Wir haben uns bewusst technologieoffen aufgestellt“, betont Furchheim im Hinblick auf die noch fehlende Wasserstoff-Infrastruktur. Er verspricht: „So können wir mit klassischen Treibstoffen, elektrisch und künftig auch mit Wasserstoff fliegen, je nachdem, wie die Infrastruktur sich entwickelt.“

Der Marktdruck und die Konkurrenz

Obwohl ODONATA durch Partner wie die ESA und die TUM Venture Labs Aerospace unterstützt wird, bleibt der Kapitalbedarf massiv. Im Wettbewerb mit bereits etablierten Playern wie Quantum Systems muss sich das Start-up behaupten. Furchheim sieht sein Unternehmen jedoch technologisch im Vorteil.

„Wir haben zwei zentrale Vorteile“, erklärt der CEO selbstbewusst: „Zum einen haben wir eine höhere Payload mit bis zu achtzig Kilogramm, was uns ermöglicht, ganz neue Use-Cases zu bedienen.“ Zudem ermögliche die enorme Reichweite eine Überwachung von Frontabschnitten oder kritischer Infrastruktur über viele Stunden hinweg. Laut Furchheim gibt es bereits konkrete Gespräche mit Interessenten, „die genau auf so etwas warten“.

Zwischen Ethik und Skalierung

Die Ausrichtung auf den Sicherheitssektor bringt neben internationalem Interesse aus den USA, Indien oder der Ukraine auch strikte Rüstungsexportkontrollen mit sich. Auf die Frage nach den regulatorischen Hürden beim Export von Dual-Use-Gütern reagiert der Gründer zurückhaltend, deutet aber eine enge Abstimmung mit nationalen Stellen an. „Ohne zu viel zu verraten, wir sind im Gespräch mit der Bundeswehr, damit wir unser System auf diese Anforderungen hin optimieren“, erklärt Furchheim, räumt jedoch ein: „Aber es ist natürlich eine Hürde, die es nicht leichter macht.“

Der erfolgreiche Hovering-Test markiert den bisher wichtigsten Fortschritt. Der nächste entscheidende Lackmustest für ODONATA wird nun der aerodynamisch anspruchsvolle Übergang in den Reiseflug sein. Nur wenn dieser nahtlos gelingt, wird das System die wachsende internationale Nachfrage tatsächlich bedienen können.

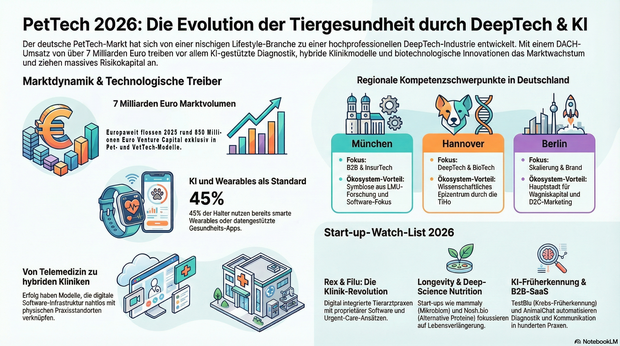

PetTech-Start-up-Report 2026

Wie DeepTech und KI den aktuellen PetTech-Markt prägen und welche Start-ups das Segment hierzulande dominieren. Plus: Die exklusive Start-up-Watch-List.

In den vernetzten De-Novo-Kliniken Berlins und Münchens scannen KI-Algorithmen heute in Millisekunden die MRT-Bilder von Haustieren, während personalisierte Longevity-Supplemente vollautomatisch an das Smart-Home der Halter geliefert werden. Der Vierbeiner des Jahres 2026 ist ein Premium-Patient und voll integrierter digitaler Lifestyle-Avatar, der eine hochkomplexe Gesundheitsökonomie antreibt. Venture-Capital-Fonds analysieren mittlerweile die Auslastungsquoten tierärztlicher Computertomographen genauso akribisch wie die wiederkehrenden Software-Umsätze im B2B-Sektor.

Wir blicken auf eine knallhart professionalisierte Industrie, in der radikale Effizienz und DeepTech den Takt angeben. Es geht um Algorithmen-gestützte Frühdiagnostik, hochskalierbare Praxis-Infrastrukturen und biotechnologische Nahrung – eine Ära, in der pure Tierliebe direkt auf tiefgreifende wissenschaftliche Innovation trifft und Investitionen in Milliardenhöhe rechtfertigt.

Ein hochreifer Milliardenmarkt unter KI-Einfluss

Der deutsche Markt für Heimtiere hat einen beispiellosen Reifegrad erreicht. Mit weit über 34 Millionen Haustieren allein in der Bundesrepublik sprechen wir von einem adressierbaren Markt, der längst nicht mehr nur Premium-Futter, sondern zunehmend hochpreisige Gesundheits- und Tech-Dienstleistungen konsumiert. Der technologische Haupttreiber im Jahr 2026 ist zweifelsohne die künstliche Intelligenz, dicht gefolgt von tiefen Integrationen des Internets der Dinge im Alltag der Tiere.

Laut einer aktuellen Bitkom-Studie nutzen mittlerweile über 45 Prozent der Halter*innen in Deutschland smarte Wearables oder datengestützte Gesundheits-Apps für ihre Tiere. Das spiegelt sich auch in den Bilanzen wider: Der Branchenumsatz im DACH-Raum hat die 7-Milliarden-Euro-Marke signifikant überschritten. Dabei flossen laut jüngsten Auswertungen von KfW Research im vergangenen Jahr europaweit rund 850 Millionen Euro Venture Capital exklusiv in Pet- und VetTech-Modelle.

Die neuen Treiber: Kliniken, Longevity und SaaS-Infrastruktur

Aktuell dominieren im PetTech-Sektor drei hochspezifische Sub-Sektoren den Markt. Allen voran steht der Bereich der De-Novo Vet-Tech-Kliniken. Hier verschmelzen physische Tierarztpraxen mit einer proprietären, durchdigitalisierten Software-Infrastruktur, die von der Terminbuchung bis zur KI-gestützten Diagnostik reicht. Etablierte Pioniere wie das Berliner Start-up Rex haben den Weg für diese hybriden Modelle geebnet.

Ein weiterer massiver Treiber ist die Pet-Longevity in Kombination mit DeepTech-Nutrition. Hier geht es nicht mehr um getreidefreies Futter, sondern um mikrobiom-basierte Nahrungsergänzungen und Alternative Proteine aus dem Bioreaktor, die das Leben der Tiere nachweislich verlängern sollen.

Der dritte dominierende Sektor ist B2B-Vet-SaaS. Start-ups bauen spezialisierte Software für Tierärzte, die Bilderkennung für Scans automatisiert und dem chronischen Fachkräftemangel in den Praxen entgegenwirkt.

Die geplatzten Träume der Solo-Telemedizin

Doch der Weg in dieses reife Marktumfeld war gepflastert mit schmerzhaften Lektionen. Der prominenteste Crash der jüngeren Vergangenheit war die spektakuläre Insolvenzwelle im Bereich der reinen Pet-InsurTechs und Solo-Telemedizin-Plattformen um das Jahr 2023 und 2024. Ein Paradebeispiel war das Berliner Neo-Versicherungs-Start-up Coya, das sich stark auf Tierversicherungen fokussiert hatte, vom französischen Konkurrenten Luko geschluckt wurde und letztlich in einem Insolvenzverfahren endete. Gleichzeitig verbrannten reine Tele-Vet-Apps, die ohne eigene physische Kliniken operierten, Millionen an VC-Geldern.

Aus diesen Debakeln lassen sich vier konkrete, fatale Fallstricke für heutige Gründer ableiten. Erstens die tödliche B2C-Kund*innenakquisitions-Falle: Wer heute im Pet-Bereich rein auf Performance-Marketing in sozialen Netzwerken setzt, wird von den astronomischen Customer Acquisition Costs erdrückt. Zweitens die Ignoranz gegenüber der Regulatorik, insbesondere der Gebührenordnung für Tierärzte. Der Gebührenschock der vergangenen Jahre brach Geschäftsmodellen das Genick, die diese Preissteigerungen nicht einkalkuliert hatten. Drittens das Dogma, dass Technologie den persönlichen Kontakt ersetzen kann: Haustiere können nicht ausschließlich über einen Bildschirm behandelt werden; wer keine physischen Anlaufstellen hat, scheitert an der Realität der Tiermedizin. Viertens die Vernachlässigung der Unit Economics zugunsten eines ungesunden Wachstums, was in einem Markt mit starker lokaler Bindung unweigerlich zum Cashflow-Kollaps führt.

Das deutsche PetTech-Netzwerk

Die deutsche PetTech-Landschaft hat sich auf wenige, aber extrem leistungsstarke Hubs konzentriert. München führt diese Liste unangefochten an. Mit der Ludwig-Maximilians-Universität, die eine der weltweit angesehensten tierärztlichen Fakultäten beheimatet, und dem InsurTech Hub Munich entsteht hier die perfekte Symbiose aus medizinischer Forschung und starkem B2B-Software-Fokus. Hannover verteidigt seinen Status als wissenschaftliches Epizentrum durch die Stiftung Tierärztliche Hochschule Hannover. Aus dem Umfeld dieser Elite-Forschungseinrichtung entspringen derzeit die tiefgreifendsten DeepTech- und BioTech-Ausgründungen der Branche. Berlin hingegen bleibt die unangefochtene Hauptstadt für Skalierung, Wagniskapital und D2C-Brandbuilding. Hier sitzen die großen Geldgeber*innen und Marketing-Genies, gestützt durch lokale Netzwerke. Leipzig komplettiert das Quartett als aufstrebender Star: Die Kombination aus der Veterinärmedizinischen Fakultät der Universität Leipzig und der BioCity, einem exzellenten Cluster für Biotechnologie, zieht zunehmend Start-ups an, die an der Schnittstelle von Tiergesundheit und Zellbiologie arbeiten.

Investor*innen-Radar

Das Kapital fließt heute intelligenter und zielgerichteter. Bei den spezialisierten VCs dominieren Fonds wie Five Seasons Ventures, die tiefes Verständnis für die Schnittstelle von FoodTech und Pet-Nutrition mitbringen, sowie global agierende Vehikel wie der Companion Fund. Im Bereich der Top-Tier Generalisten haben europäische Schwergewichte wie Cherry Ventures, Vorwerk Ventures und DN Capital den Sektor für sich entdeckt und pumpen beträchtliche Summen in hybride Klinik-Modelle und B2B-SaaS. Ein wesentlicher Machtfaktor sind mittlerweile die Corporate VCs der Industrie. Fressnapf dominiert mit seiner Beteiligungsgesellschaft die Früh- und Wachstumsphase strategisch, während Mars Petcare über seinen Arm Kinship massiv nach Europa drängt.

Der eigentliche Motor der Innovation liegt jedoch bei den Frühphasen-Motoren und Business Angels. Hier brillieren Köpfe wie Lukas Keindl, der als Gründer des US-Vorbilds Bond Vet nun aktiv sein Know-how und Kapital in die europäische Gründerszene pumpt, sowie spezialisierte Angel-Syndikate und Netzwerke wie der Auxxo Female Catalyst Fund, die gezielt diverse Gründungsteams in der Tiermedizin fördern.

Die Top-PetTech-Start-ups (Must-Watch)

Die nachfolgende Auswahl der Top Start-ups basiert auf einer strengen redaktionellen Analyse. Die zentralen Kriterien für die Aufnahme in dieses Ranking sind eine nachgewiesene Marktrelevanz durch messbares Praxis- oder Nutzerwachstum, ein hoher technologischer Reifegrad fernab reiner Konzeptphasen sowie das ausdrückliche Vertrauen namhafter Lead-Investoren. Um die aktuelle Innovationskraft des deutschen Ökosystems abzubilden, haben wir uns ausschließlich auf deutsche Start-ups konzentriert, deren Gründung im Jahr 2020 oder später erfolgte. Die Liste beleuchtet bewusst eine Diversität an Geschäftsmodellen, von B2B-Software über BioTech bis hin zu hybriden Versorgungskonzepten.

Rex

Das im Jahr 2021 von Julian Lechner und Jonathan Loesing gegründete Berliner Start-up Rex ist das aktuelle Paradebeispiel für moderne Tiermedizin. Rex kombiniert ein B2B/B2C-Hybrid-Modell und baut architektonisch anspruchsvolle, digital voll integrierte T Tierärzt*innenpraxen auf. Der USP liegt in der proprietären Praxismanagement-Software, die den Tierärzt*innen die Administration abnimmt, und der nahtlosen App-Experience für den Tierhalter. Das enorme Potenzial dieses Modells überzeugte Vorwerk Ventures, Picus Capital und weitere namhafte Investor*innen, die dem Unternehmen bereits zweistellige Millionenbeträge anvertrauten.

Filu

Ebenfalls angetreten, um den chronisch überlasteten Tierärzt*innenmarkt zu revolutionieren, ist das Münchner Start-up Filu. Gegründet 2022 von Anna Magdalena Naderer, Christian Köhler und Justus Buchen, positioniert sich das Unternehmen mit seinem Urgent-Care-Ansatz gekonnt zwischen klassischer Allgemeinpraxis und Notfallklinik. Die Kombination aus modernster Hardware vor Ort und smarten Tele-Triage-Prozessen im Hintergrund sorgt für eine extrem hohe Effizienz. Lead-Investoren wie DN Capital und YZR Capital haben das immense Skalierungspotenzial früh erkannt und die Expansionspläne befeuert.

mammaly

Im Bereich der D2C-Tiergesundheit setzt das 2020 in Köln von Stanislav Nazarenus und Alexander Thelen gegründete Start-up mammaly neue Standards. Das Geschäftsmodell basiert auf dem Direktvertrieb von hochwirksamen, mit Tierärzt*innen entwickelten Nahrungsergänzungsmitteln in Snackform. Der USP liegt in der tiefgreifenden Fokussierung auf das Mikrobiom von Hunden, um altersbedingte Beschwerden proaktiv zu lindern. Dieses datengetriebene und markenstarke Konzept sicherte mammaly unter anderem ein substanzielles Funding durch den spezialisierten VC Five Seasons Ventures.

PetLEO

Dieses 2020 in München von Karim Abdo und Bülent Hacioglu gegründete Unternehmen agiert als eine hochkomplexe B2B2C-Gesundheitsplattform. PetLEO verbindet Tierärzt*innen, Expert*innen und Haustierbesitzer*innen in einem geschlossenen, digitalen Ökosystem. Tierhalter*innen können Gesundheitsdaten verwalten, Giftköder-Warnungen erhalten und Termine buchen, während die Praxen selbst eine moderne Schnittstelle zur Kund*innenbindung erhalten. Das Start-up hat sich durch starke Partnerschaften mit Industrie und Versicherungen eine äußerst wehrhafte Marktposition als digitaler Alltagsbegleiter erarbeitet.

Hundeo

Dass man auch ohne massive externe Kapitalrunden im PetTech-Markt dominieren kann, beweist das 2020 von Enrico Bachmann in Berlin gegründete Start-up Hundeo. Das B2C-EdTech-Modell ist eine gamifizierte App für modernes Hundetraining. Der technologische USP ist die personalisierte, KI-gestützte Trainingsplanung, die sich dem Lernfortschritt des jeweiligen Tieres anpasst. Mit enormem organischem Wachstum und starker Nutzer*innenbindung gehört das gebootstrappte Hundeo zu den profitablen Vorzeige-Start-ups der App-Economy.

Nosh.bio

Obwohl nicht exklusiv für den Pet-Markt gegründet, rüttelt das 2022 von Tim Fronzek und Felipe Lino in Berlin ins Leben gerufene DeepTech-Start-up Nosh.bio die Tiernahrungsindustrie fundamental auf. Das B2B-Geschäftsmodell fokussiert sich auf die Herstellung von Alternativen Proteinen aus Pilzmyzel. Der technologische USP liegt in einem hocheffizienten Fermentationsprozess, der saubere, hochverdauliche und texturstarke Proteinquellen aus Pilzmyzel liefert. Als hochfunktionale „Clean-Label“-Zutat ermöglicht sie die Entwicklung erstklassiger, fleischfreier Tiernahrung – völlig ohne chemische Zusätze und ohne den massiven ökologischen Fußabdruck der konventionellen Fleischindustrie. Lead-Investor Earlybird unterstützt dieses zukunftsweisende BioTech-Modell.

TestBlu

Mit Gründung im Jahr 2022 in Potsdam bringt TestBlu echte Deep-Science in die tierärztliche Praxis. Das von Shahab Shoaei Matin geführte Geschäftsmodell ist ein KI-gestütztes B2B-SaaS-Produkt für Veterinärkliniken. Der USP des Unternehmens ist Deutschlands erster Bluttest zur Früherkennung von Krebs bei Hunden. Ein hochkomplexer Algorithmus analysiert Blutbilder auf Anomalien mit enormer Präzision. TestBlu positioniert sich als unverzichtbarer onkologischer Co-Pilot für Tierärzt*innen, um die diagnostische Sicherheit drastisch zu erhöhen.

AnimalChat

Die 2020 von Sebastian Wilkes und dem erfahrenen Tierarzt Dr. Heinrich Wilkes aus Borken gestartete B2B-Software AnimalChat hat das Problem der ineffizienten Kommunikation in Praxen radikal gelöst. Das Start-up bietet einen DSGVO-konformen, professionellen Messenger-Dienst speziell für Veterinär*innen und deren Klient*innen an. Der USP ist die nahtlose Integration von asynchroner Kommunikation und digitaler Wundverlaufskontrolle, ohne dass der Arzt bzw. die Tierärztin seine bestehende Praxissoftware austauschen muss. Dieses pragmatische, aber hochskalierbare Tool hat sich in hunderten Praxen als Standard etabliert.

Internationaler Ausblick & Fazit

Wer heute verstehen will, was morgen in Europa passiert, muss den Blick zwingend über den Tellerrand richten. Drei globale Makro-Trends werden den deutschen PetTech-Markt in Kürze massiv umwälzen. Aus den USA schwappt die Welle der Longevity-Pillen herüber, wo Start-ups bereits erste FDA-Zulassungen für Medikamente anstreben, die das biologische Altern von Hunden verlangsamen. Asien hingegen definiert den Standard für Hyper-Vernetzung neu: Hier sind smarte Katzentoiletten und vollautomatische, mit dem Smart-Home synchronisierte Futterautomaten, die Gesundheitsdaten in Echtzeit an den Tierarzt bzw. die -ärztin senden, bereits Massenmarkt. In Israel, dem weltweiten Hub für FoodTech, verschmilzt derweil AgriTech mit Tiernahrung. Kultiviertes Fleisch aus dem Labor für Premium-Tiernahrung steht dort nach der ersten regulatorischen Marktzulassung für Heimtierfutter in Großbritannien durch das Start-up Meatly endgültig vor dem globalen Durchbruch.

Das Fazit für 2026 ist eindeutig: Der Welpenschutz für Gründer*innen ist abgelaufen. PetTech ist ein knallhartes Business, das exzellente Unit Economics, tiefes regulatorisches Verständnis und echte technologische Alleinstellungsmerkmale verlangt. Investor*innen suchen heute nach Geschäftsmodellen, die reale Engpässe wie den Tierärzt*innenmangel lösen oder die Lebensspanne der Tiere durch harte Wissenschaft verlängern. Wer in diesem 20-Milliarden-Markt mitspielen will, muss beweisen, dass er/sie nicht nur Tiere liebt, sondern vor allem sein/ihr strategisches und technologisches Handwerk versteht.

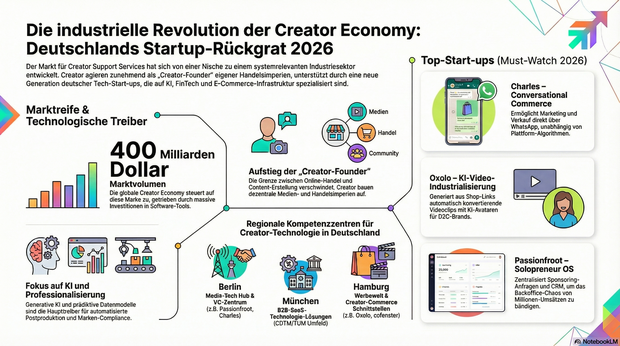

Start-up-Report: Creator Support Services

Die industrielle Revolution der Creator*innen ist in vollem Gange: Unser Report beleuchtet den boomenden Markt und zeigt die deutschen Tech-Start-ups, die das Rückgrat der neuen Medien-Champions bauen.

Wir erleben das Entstehen einer neuen ökonomischen Spezies: Der Creator-Founder. Die Grenze zwischen dem/der klassischen Online-Händler*in und dem/der modernen Content-Creator*in ist endgültig gefallen. Wer heute Reichweite besitzt, baut keine Community mehr auf, sondern ein dezentrales Medien- und Handelsimperium. Diese Transformation vom Nischenthema zur Systemrelevanz braucht jedoch eine industrielle Basis. Genau hier betritt eine neue Generation von Start-ups die Bühne. Diese „Werkzeugmacher*innen“ – spezialisiert auf KI-gesteuerte Produktion, autonome Analyse und FinTech – bilden das unsichtbare, hochprofitable Rückgrat einer Branche, die gerade ihre industrielle Revolution erlebt.

Das Ökosystem wird erwachsen

Die Marktlage im Jahr 2026 beweist eindrucksvoll, dass die Werkzeug-Infrastruktur für digitale Entrepreneur*innen den Kinderschuhen entwachsen ist. Laut aktuellen Hochrechnungen etablierter Investmentbanken steuert die globale Creator Economy unaufhaltsam auf die 400-Milliarden-Dollar-Marke zu, wobei ein signifikanter zweistelliger Prozentsatz direkt in Software- und Servicetools fließt.

Auch in Deutschland bestätigt der jüngste KfW-Gründungsmonitor diese Reife: Software-Lösungen für digitale Medienschaffende gehören zu den widerstandsfähigsten B2B-Segmenten der Post-Krisen-Ära. Der technologische Haupttreiber dieser rasanten Professionalisierung ist zweifellos die angewandte generative künstliche Intelligenz, dicht gefolgt von prädiktiven Datenmodellen. Deutsche Risikokapitalgeber*innen haben im vergangenen Jahr schätzungsweise über 350 Millionen Euro spezifisch in dieses Vertical gepumpt. Es geht längst nicht mehr um experimentelles Wagniskapital, sondern um Growth-Metriken und wiederkehrende SaaS-Umsätze in einem Markt, der eine beispiellose Professionalisierung erfährt.

Technologien der totalen Integration

Blickt man jenseits der offensichtlichen Dashboards, offenbaren sich die wahren Maschinenräume dieses Jahres. Drei Sub-Sektoren dominieren aktuell das Geschehen und treiben die Verschmelzung von Commerce und Content voran. Zunächst ist da die autonome KI-Postproduktion, bei der Algorithmen nicht nur schneiden, sondern selbständig Narrative für Verkaufsformate generieren.

Ein weiterer massiver Treiber ist die prädiktive Marken-Compliance. Hierbei handelt es sich um Legal-Tech-Lösungen, die vollautomatisiert Werbekennzeichnungspflichten und internationale Steuermodelle für Creator-Marken überwachen.

Schließlich etabliert sich das Creator FinTech, insbesondere durch umsatzbasierte Finanzierungsmodelle, die den dynamischen Cashflow von Influencer-Brands algorithmisch bewerten können. Während Pioniere der ersten Welle wie Linktree lediglich Brücken bauten, stoßen die aktuellen Akteure tief in diese hochkomplexen, technologischen Nischen vor, um den Creator*innen als vollwertigen E-Commerce-Akteur*innen zu befähigen.

Reality Check: Der Kater nach dem Hype

Dass diese Branche jedoch kein automatischer Garant für Einhörner ist, bewies der spektakuläre Crash der Web3-Creator-Plattformen um das Jahr 2023. Hochgelobte Projekte wie BitClout verbrannten Hunderte Millionen Dollar an Risikokapital, weil sie die Usability vernachlässigten und keinen echten Nutzwert jenseits der Spekulation boten. Aus diesem schmerzhaften Reality Check lassen sich vier fatale Fallstricke für heutige Gründer*innen ableiten. Der erste Fehler ist das API-Klumpenrisiko, also die blinde Abhängigkeit von den Launen großer Plattformen wie Meta oder YouTube. Ein zweites, oft tödliches Problem sind katastrophale Unit Economics bei Tools, die nur den nicht-monetarisierbaren "Long Tail" der Hobby-Nutzer*innen bedienen. Der dritte Fallstrick ist die chronische Unterschätzung der Regulatorik, insbesondere des EU AI Acts. Das vierte Learning betrifft den Technologie-Fetischismus: Wer Lösungen aufzwingt, die technologisch brillieren, aber in der alltäglichen User Experience der Creator*innen versagen, wird vom Markt gnadenlos abgestraft.

Deutschlands heimliche Creator-Hubs

Die architektonische Landkarte der deutschen Creator-Tool-Landschaft konzentriert sich 2026 auf hochspezialisierte Hotspots. Berlin bleibt der unangefochtene Magnet, angetrieben von einer dichten Konzentration an Media-Tech-VCs und der Strahlkraft von Kaderschmieden wie der ESMT. München agiert als das kraftvolle Gegenstück für harte Technologiebedingungen. Angefacht durch das CDTM und die TU München, entstehen hier vor allem datenlastige B2B-SaaS-Produkte für die Industrie. Das Rheinland, spezifisch die Achse Aachen und Köln, fungiert als historisch gewachsenes Cluster, das auf dem Fundament klassischer TV-Produktionen und starken Informatik-Fakultäten wie der RWTH Aachen basiert. Abgerundet wird dieses Netzwerk durch Hamburg. Die Hansestadt nutzt ihre tiefe Verwurzelung in der Werbe- und Agenturwelt sowie Netzwerke wie den Next Media Accelerator, um Tools zu entwickeln, die genau an der Schnittstelle zwischen Markenbudgets und der Creator-Commerce-Welt ansetzen.

Investor*innen-Radar

Ein genauer Blick auf die Geldgeber*innen offenbart, wer das Benzin für diese Maschine liefert. Bei den spezialisierten VCs haben Akteure wie Creator Ventures den Takt vorgegeben, während in Deutschland vor allem Vehikel rund um OMR Ventures den tiefen Brancheneinblick für Seed-Finanzierungen nutzen. Auf der Ebene der Top-Tier Generalisten sehen wir Fonds wie Creandum, Cherry Ventures und Point Nine, die ihre rigorosen B2B-SaaS-Metriken nun konsequent auf Creator-Tools anwenden. Die Industrie mischt über Corporate VCs ebenfalls kräftig mit; hier sichern sich Bertelsmann Investments oder SevenVentures strategische Marktanteile, um ihre eigenen Wertschöpfungsketten zu digitalisieren. Der eigentliche Motor der Frühphase sind jedoch die Business Angels und Syndikate. Hier agieren Digitalgrößen wie Philipp Westermeyer oder Prominente wie Mario Götze als strategische Türöffner, die den Start-ups unmittelbaren Zugang zu jener Creator-Elite verschaffen, die heute die Märkte bewegt.

Die Top Start-ups (Must-Watch 2026)

Die für diesen Report ausgewählten Start-ups wurden anhand einer rigorosen Analyse ihrer Marktrelevanz im Jahr 2026, ihres technologischen Reifegrades sowie der Stabilität ihrer Geschäftsmodelle bewertet. Ein wesentliches Kriterium war zudem das Investoren-Vertrauen durch namhafte Risikokapitalgeber. Wir betrachten ausschließlich Unternehmen mit Hauptsitz in Deutschland, die ab dem Jahr 2020 gegründet wurden, um den aktuellen Innovationszyklus der "Post-Plattform-Ära" präzise abzubilden – jene Ära, in der Creator zu echten Handelsmarken werden.

Passionfroot (Gegründet 2021)

Das Team um Jennifer Phan, Jens Willemen und Michelle Tian hat von Berlin aus einen globalen Standard gesetzt. Ihr B2B-SaaS-Modell bietet einen ganzheitlichen Workspace, der Sponsoring-Anfragen und CRM für Creator zentralisiert. Der USP ist die radikale Vereinfachung des Backoffice-Chaos für jene „Solopreneur*innen“, die heute Millionenumsätze verwalten. Namhafte VCs wie Creandum und Cherry Ventures investierten hier in einer Seed-Runde 3 Millionen Euro in Passionfroot.

Nindo (Gegründet 2020)

Gegründet von Rezo und Tim Jacken in Aachen, ist Nindo der Inbegriff für den Sprung von Content-Expertise zu tiefen B2B-Data-SaaS-Lösungen. Das Unternehmen bietet granularste Analytics und Reichweiten-Validierungen für das Influencer-Marketing. Durch den Einstieg und die strategische Partnerschaft mit dem globalen Medienhaus Webedia stützt Nindo heute maßgeblich das Wachstum jener Marken, die auf datenbasierte und verifizierte Creator-Kooperationen setzen.

cofenster (Gegründet 2020)

Die Hamburger Gründer Tom Vollmer, Oliver Wegner und Finn Frotscher adressieren die „Corporate Creator Economy“. Ihr Tool ermöglicht es Unternehmen, Mitarbeiter-Content via KI-Guidance in professionelle Verkaufs- und Info-Videos zu verwandeln. Dieser Ansatz sicherte cofenster unter anderem eine Seed-Finanzierung in Höhe von 1,5 Millionen Euro, angeführt von Capnamic Ventures.

Charles (Gegründet 2020)

Artjem Weissbeck und Andreas Tussing bringen mit Charles Conversational Commerce nach Berlin. Ihr SaaS-Modell erlaubt es E-Commerce- und Creator-Brands, Marketing und Verkauf vollständig über WhatsApp abzuwickeln. Der USP liegt in der direkten Monetarisierung ohne Algorithmus-Abhängigkeit, was Salesforce Ventures im Rahmen einer Series-A-Runde zu einem Investment von 20 Millionen Dollar veranlasste.

Wonnda (Gegründet 2022)