Aktuelle Events

Was gehört in eine KI-Policy?

Recht für Gründer*innen: Über den verantwortungsvollen Umgang mit KI.

Künstliche Intelligenz (KI) ist längst Teil unseres Alltags und hält in Unternehmen auch zunehmend Einzug. Ob beim Erstellen von Texten, in der Datenanalyse oder bei der Automatisierung von Routineaufgaben – KI ist ein starkes Werkzeug, das Unternehmen viele Vorteile bieten kann. Doch mit diesen Vorteilen kommen auch Verantwortung und Risiken, die eine klare und durchdachte KI-Policy erfordern.

Diese Einleitung zu einem Artikel über KI-Policies ist KI-generiert. Es ist so schön bequem und schnell gemacht: eines der gängigen LLM-Systeme online aufrufen, beispielsweise ChatGPT, und binnen Sekunden ist der Artikel fertig.

Ihr kennt das im Privaten, vor allem aber auch im Arbeitsumfeld. KI-Tools sind aus der Arbeitswelt nicht mehr wegzudenken. Die Nutzung von KI – insbesondere für berufliche Aufgaben – birgt jedoch Risiken. Manche KI neigt, falsch trainiert, zu diskriminierenden Entscheidungen, was z.B. im HR-Bereich gefährlich ist. Unbedacht erstellte Prompts können den Schutz von Geschäftsgeheimnissen aufs Spiel setzen. Die Datenschutzgrundsätze sind wie immer einzuhalten.

Generative KI schert sich, wenn wir als Nutzer*innen nicht darauf Acht geben, nicht um die Urheberrechte derer, deren Werke wir – ob bewusst oder unbewusst – verwenden oder verletzen. Zudem ist seit August 2024 die KI-Verordnung in der EU in Kraft und stellt an Unternehmen, die KI-Systeme und -Modelle entwickeln, anbieten oder betreiben, umfangreiche Anforderungen. Auch die mit KI einhergehenden Risiken sind nicht außer Acht zu lassen.

Seid ihr als Gründer*innen oder in sonst verantwortlicher Position in einem Unternehmen mit mehreren Mitarbeiter*innen tätig, müsst ihr euch Gedanken darüber machen, wie solche Risiken zu fassen und zu begrenzen sind. Tut ihr das nicht, drohen aus diversen Rechtsgrundlagen z.B. Schadensersatzforderungen, Bußgelder oder der Verlust an Assets – Dinge, die allerspätestens bei der nächsten Finanzierungsrunde negativ bewertet werden. In Bezug auf eure Belegschaft müsst ihr also Awareness für diese Themen schaffen und konkrete Vorgaben machen.

Denn eines ist klar: KI wird in eurem Unternehmen genutzt werden, ob mit oder ohne euer Wissen. Und bevor die Mitarbeiter*innen auf privaten Geräten sensible berufliche Aufgaben nicht reglementiert mittels ChatGPT & Co. lösen, beschreibt lieber beizeiten Dos and Don’ts, um sicherstellen, dass KI verantwortungsvoll, sicher und rechtskonform im Unternehmen eingesetzt wird.

Dazu dient eine die Belegschaft informierende und verpflichtende KI-Policy. Im Folgenden findest du einen Überblick darüber, welche Aspekte in eine solche Policy gehören.

1. Richtlinien für den Einsatz generativer KI am Arbeitsplatz

Generative KI-Modelle wie ChatGPT, DALL-E und andere erstellen Inhalte nach Maßgabe der Eingaben der Nutzenden. Bei diesen Prompts und bei der Verwendung der generierten Ergebnisse ist auf Folgendes zu achten:

- Schutz sensibler Daten: Die Eingabe vertraulicher Informationen in KI-Modelle stellt ein erhebliches Risiko dar, da generative KI-Systeme auf großen Datenmengen trainiert sind und Informationen potenziell unkontrolliert verarbeiten und speichern. Die KI-Policy sollte explizit verbieten, sensible oder vertrauliche Informationen in generative KI-Systeme einzugeben, insbesondere, wenn diese extern betrieben werden. Die Policy sollte beschreiben wie mit sensiblen Daten umzugehen ist und welche Daten für die Verarbeitung durch KI-Systeme ungeeignet sind.

- Einhaltung des Datenschutzes: Die KI-Policy sollte klarstellen, dass der Einsatz generativer KI-Tools den Anforderungen der Datenschutzgesetze (DSGVO, BDSG) entsprechen muss. Dazu gehören Vorgaben, wie personenbezogene Daten rechtssicher zu handhaben sind und welche dieser Daten überhaupt für den Einsatz von KI-Modellen geeignet sind. Zudem bedarf es Vorgaben zur Anonymisierung und Pseudonymisierung der Daten, daneben Transparenzvorgaben, um betroffene Personen über die Nutzung ihrer Daten zu informieren. Personenbezogene Daten in öffentlichen KI-Systemen einzusetzen, sollte möglichst untersagt werden.

- Umgang mit geistigem Eigentum: Die Nutzung generativer KI-Modelle kann zu Problemen führen, wenn die KI auf geschütztem Material trainiert wurde, von dem/der Nutzenden urheberrechtlich geschützte Werke in den Prompt einbezogen werden oder die KI Werke erstellt, die bestehende Urheber- oder sonstige Schutzrechte verletzen. Die KI-Policy sollte ein Verbot der Verwendung von Werken enthalten, an denen nicht die für die Bearbeitung erforderlichen Rechte bestehen. Und sie kann Regelungen zur Überprüfung und Genehmigung von KI-erstellten Inhalten festlegen, etwa durch eine Rechtsabteilung oder eine speziell dafür zuständige Stelle.

- Transparenz und Kennzeichnung: Die KI-Policy sollte festlegen, dass Inhalte, die mithilfe von generativer KI erstellt wurden, transparent gekennzeichnet werden. Dies trägt dazu bei, Missverständnisse zu vermeiden und sicherzustellen, dass die Herkunft von Texten und Bildern klar erkennbar ist. Diese Kennzeichnungspflicht sollte insbesondere dann gelten, wenn KI-generierte Inhalte veröffentlicht werden, aber auch im internen Gebrauch.

- Positivliste erlaubter KI-Systeme: Um die Mitarbeiter*innen mit der Anwendung dieser Vorgaben auf einzelne am Markt angebotene KI-Systeme nicht allein zu lassen, kann eine KI-Policy auch eine Auflistung der vom Unternehmen freigegebenen Systeme enthalten. Voraussetzung ist dafür natürlich, dass diese Systeme vorab entsprechend fachlich geprüft wurden. Das kann schwierig sein, weil sich Anbieter*innen meist nicht in die Karten schauen lassen.

2. Richtlinien für die Entwicklung und Implementierung von KI

Auch wenn ihr in eurem Unternehmen KI-Systeme entwickeln oder implementieren wollt, sind ethische, rechtliche und technische Anforderungen in einer KI-Policy zu adressieren.

- Fairness, Transparenz und Nichtdiskriminierung: KI-Systeme können, wenn sie auf verzerrten Datensätzen trainiert werden, Diskriminierung oder Vorurteile reproduzieren. Eine KI-Policy sollte deshalb klare ethische Richtlinien festlegen, die sicherstellen, dass die entwickelten Modelle fair, transparent und frei von Diskriminierung sind. Ein mögliches Vorgehen ist, regelmäßige Audits und Bias-Tests durchzuführen und in der Policy verpflichtend vorzusehen, um Verzerrungen frühzeitig zu erkennen und zu beheben.

- Datenschutz und Datensicherheit: Der verantwortungsvolle Umgang mit Nutzer*innendaten ist eine der wichtigsten Anforderungen in der KI-Entwicklung. Die KI-Policy sollte festlegen, dass bei der Verarbeitung personenbezogener Daten durch die KI strenge Schutzanforderungen, am besten strenge Begrenzungen, gelten. Rein automatisierte Entscheidungen sind schon laut DSGVO verboten. Es sollten nur die für die jeweilige Anwendung notwendigen Daten erhoben und verarbeitet werden, und diese Daten sollten weitestgehend anonymisiert oder pseudonymisiert werden. Regelungen für den Zugang zu diesen Daten sowie Maßnahmen zur Datensicherheit (wie Verschlüsselung und Zugriffskontrollen) sollten ebenfalls Bestandteil der Policy sein.

- Überprüfung auf Halluzinationen und Fehlinterpretationen: Generative KI-Modelle neigen dazu, Informationen zu „halluzinieren“, also falsche oder ungenaue Inhalte zu erstellen. In der KI-Policy sollte festgelegt sein, dass entwickelte KI-Modelle regelmäßig auf ihre Genauigkeit und Zuverlässigkeit überprüft werden. Dies kann durch vorgeschriebene Tests und Simulationen geschehen, bei denen die KI in verschiedenen Szenarien eingesetzt und auf ihre Fähigkeit, korrekte Ergebnisse zu liefern, geprüft wird. Es sollten auch definiert werden, wie Fehler erkannt und behoben werden können.

- Erklärbarkeit und Nutzer*infreundlichkeit: Komplexe KI-Modelle sind oft schwer verständlich und wirken wie eine Black Box, deren Entscheidungen für Außenstehende kaum nachvollziehbar sind. Die KI-Policy sollte daher sicherstellen, dass die KI so gestaltet ist, dass ihre Funktionsweise für Nutzer*innen transparent und nachvollziehbar ist. Dies ist insbesondere dort wichtig, wo KI-Entscheidungen schwerwiegende Auswirkungen haben können. Ihr solltet sicherstellen, dass für Nutzer*innen eine verständliche Erläuterung darüber bereitgestellt wird, wie und warum die KI zu einem bestimmten Ergebnis gelangt ist. Das ist Voraussetzung für Kontrolle und rechtskonformen Betrieb der KI.

- Gesetzeskonformität gemäß KI-Verordnung: Nicht zuletzt hat die Europäische Union die KI-Verordnung in Kraft gesetzt, die strenge Anforderungen an die Entwicklung und Nutzung von KI stellt. Die KI-Verordnung dient der Produktsicherheit und verlangt zunächst eine Risikoeinschätzung für die KI-Systeme. Die Maßgaben für eine solche Einschätzung sollten in der Policy angerissen und No-Gos für die Entwicklung von Funktionalitäten, die zu den laut KI-Verordnung verbotenen KI-Anwendungen gehören, ausgesprochen werden. Für sogenannte Hochrisiko-KI-Systeme gelten besondere Anforderungen, die bei einer Entwicklung mitgedacht werden müssen, wofür eine KI-Policy zumindest sensibilisieren sollte. Die im Einzelfall geforderte Überprüfung und Einstufung des jeweiligen Systems oder Modells kann eine Policy nicht leisten. Die initialen und regelmäßigen Überprüfungen sowie Risikobewertungen sollte sie aber fordern.

- Regelmäßige Überwachung und Wartung der KI-Modelle: KI-Modelle entwickeln sich weiter und benötigen regelmäßige Überwachung und Wartung, um die Leistung zu optimieren und mögliche Fehler zu minimieren. Die KI-Policy sollte eine solche sich wiederholende Maintenance festlegen, etwa die schon erwähnten regelmäßigen Aktualisierungen, Fehlerbehebungen und Performance-Überprüfungen, damit die KI-Systeme immer den aktuellen Standards und Anforderungen entsprechen.

3. Übergreifende Ziele und Vorgaben einer KI-Policy

Eine KI-Policy sollte nicht nur detaillierte Vorgaben zur Nutzung und Entwicklung von KI enthalten, sondern auch allgemeine Leitlinien und Prinzipien für den Einsatz von KI im Unternehmen, um ein Bewusstsein für die Potenziale und Risiken der Technologie zu schaffen.

- Regelmäßige Überprüfung und Anpassung: Da sich KI-Technologien und gesetzliche Anforderungen stetig weiterentwickeln, sollte auch die KI-Policy regelmäßig überprüft und aktualisiert werden. Dies hilft sicherzustellen, dass das Unternehmen stets auf dem neuesten Stand ist und seine KI-Systeme konform mit den aktuellen gesetzlichen, ethischen und technischen Standards sind. Es ist empfehlenswert, regelmäßige Audits durchzuführen und die Policy an neue Entwicklungen in der KI-Forschung und Gesetzgebung sowie an die Marktanforderungen anzupassen.

- Unternehmenskultur in Bezug auf KI: Eine KI-Policy sollte dazu dienen, den transparenten und offenen Umgang mit KI in allen Unternehmensbereichen und damit die Akzeptanz für KI-Systeme sowohl innerhalb des Unternehmens als auch bei Kund*innen und Partner*innen zu fördern. Dazu gehört auch, dass das Unternehmen offenlegt, in welchen Bereichen KI eingesetzt wird und welche Entscheidungen die Technologie beeinflusst. Letztendlich ist die KI-Policy ein Instrument zur Förderung einer verantwortungsvollen und ethischen Unternehmenskultur in Bezug auf KI. Das schützt letztlich auch die Integrität und die Werte des Unternehmens.

- Schulungen und Sensibilisierungsmaßnahmen: Um einen solchen kompetenten und verantwortungsvollen Umgang mit KI zu erreichen, sind regelmäßige Schulungen und Sensibilisierungsmaßnahmen für die Mitarbeiter*innen zu den hier genannten Aspekten vorzusehen.

Fazit

Dieser Artikel kann nur einen groben Überblick und Rahmen geben. Die konkreten Inhalte einer auf eure Belange und Nutzungsformen passenden Policy müsst ihr in Anschauung der Spezifika der eingesetzten oder zu entwickelnden KI-Systeme erarbeiten. Das kann auch schlecht an KI delegiert werden: Der Rest des eingangs erwähnten KI-generierten Artikels war nicht wirklich brauchbar, ebenso die testweise mit KI erstellten Policies. Dafür braucht es professionelle Unterstützung.

Der Autor Dr. Daniel Michel, LL.M. ist seit 2004 als Rechtsanwalt im Bereich IT/IP/Technologie tätig. Nach Stationen in spezialisierten und Großkanzleien betreibt er seit 2018 seine eigene Rechtsberatung im Raum München, www.datalawcounsel.com

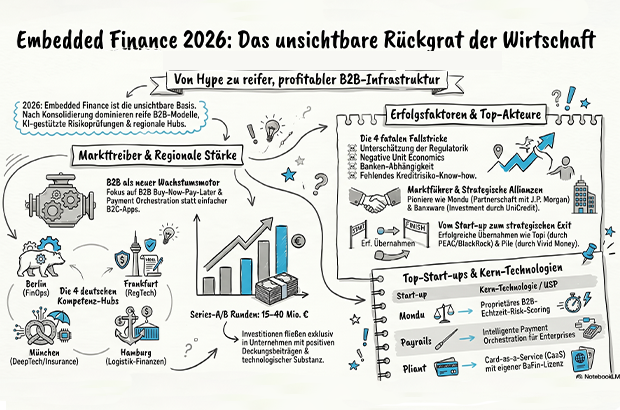

Embedded-Finance-Start-up-Report 2026

Der unsichtbare Bankensektor: Wie Embedded Finance und die dazugehörigen Start-ups die Wirtschaft des Jahres 2026 prägen.

Einst war es das große Versprechen für eine Handvoll hipper Neobanken, heute ist es das unsichtbare Rückgrat der europäischen Wirtschaft: Embedded Finance. Im Jahr 2026 wird das Marktwachstum längst nicht mehr von der fixen Idee isolierter Bank-Apps dominiert, denn jedes zukunftsorientierte Unternehmen ist mittlerweile selbst zu einem/einer Finanzdienstleister*in geworden. Ob Software-as-a-Service-Anbieter*in, Logistik-Plattform oder Marktplatz – die nahtlose Integration von Zahlungen, Krediten und Versicherungen in nicht-finanzielle Kund*innenreisen ist das neue Paradigma.

Dieser Report beleuchtet eine Branche, die den „Sturm der Konsolidierung“ überlebt hat und nun mit reifen Geschäftsmodellen und echten Profiten die Architektur der modernen Wirtschaft neu programmiert.

Vom Hype zur fundamentalen Reife

Nach den massiven Zinsanpassungen und regulatorischen Aufräumarbeiten der Jahre 2023 und 2024 zeichnet der Embedded-Finance-Markt heute ein Bild robuster Reife. Renommierte Analystenhäuser wie Bain & Company und Dealroom haben diese Entwicklung früh vorgezeichnet: Der globale Markt für Embedded-Finance-Dienstleistungen hat sich in ein Multimilliarden-Segment verwandelt, dessen europäisches Transaktionsvolumen mittlerweile signifikante Teile des digitalen B2B- und B2C-Handels stützt. Der technologische Haupttreiber dieser neuen Ära ist unbestreitbar die künstliche Intelligenz, genauer gesagt proprietäre Machine-Learning-Modelle, die Risikobewertungen in Millisekunden durchführen und Transaktionsströme dynamisch optimieren. Investor*innen honorieren diese technologische Tiefe: Wir sehen heute höchst realistische Series-A- und Series-B-Runden im Bereich von 15 bis 40 Millionen Euro für Start-ups, die nachweislich positive Deckungsbeiträge aufweisen. Es fließt wieder signifikant Kapital, doch es fließt exklusiv in Substanz und Skalierbarkeit, nicht mehr in reines Marketing.

Die neuen Treiber: B2B, Vertikalisierung und Orchestrierung

Wenn man über das Offensichtliche wie einfache White-Label-Kreditkarten hinausblickt, dominieren im Jahr 2026 drei spezifische Sub-Sektoren den Markt. Allen voran steht B2B Buy-Now-Pay-Later, eine Disziplin, die das traditionelle, schwerfällige Factoring abgelöst hat und nun direkt in B2B-Checkouts und Beschaffungsnetzwerke integriert ist. Ein weiterer massiver Treiber ist die sogenannte Payment Orchestration für vertikale SaaS-Lösungen. Hier werden komplexe, branchenspezifische Zahlungsflüsse – etwa im Handwerk oder in der Gastronomie – automatisiert im Hintergrund abgewickelt. Zuletzt etabliert sich Embedded Insurance zunehmend im Industriekontext, wo Maschinen nicht mehr nur geleast, sondern im selben Atemzug transaktionsbasiert versichert werden. Pioniere wie die Berliner Mondu oder auch europäische Schwergewichte wie Swan haben den Weg für diese hochspezialisierten Infrastruktur-Layer geebnet und gezeigt, wie tiefgreifend diese Geschäftsmodelle in die Wertschöpfungsketten der Realwirtschaft eingreifen.

Die Lektionen der BaaS-Krise

Doch dieser Reifegrad wurde teuer erkauft. Der Beinahe-Kollaps des britischen Banking-as-a-Service-Pioniers Railsr und die drastischen BaFin-Sonderprüfungen samt Wachstumsbeschränkungen bei etablierten deutschen Playern wie Solaris in den Jahren zuvor haben den Markt fundamental erschüttert. Der Traum, Finanzdienstleistungen wie einfache Legosteine zusammenzustecken, kollidierte brutal mit der harten Realität des Bankwesens.

Aus diesen gescheiterten Hoffnungen lassen sich für heutige Gründer*innen vier konkrete, fatale Fallstricke ableiten. Der erste und wichtigste ist die eklatante Unterschätzung der Regulatorik; Compliance lässt sich nicht auslagern, und Aufsichtsbehörden dulden keine agilen Versuch-und-Irrtum-Prozesse bei der Geldwäscheprävention. Der zweite Fallstrick ist die Falle der negativen Unit Economics im B2C-Sektor, wo exorbitante Kund*innenakquisitionskosten oft nur durch kontinuierliches VC-Geld gedeckt wurden. Drittens das Klumpenrisiko der Abhängigkeit von einer einzigen Partnerbank, deren Ausfall das eigene Start-up über Nacht handlungsunfähig macht. Und viertens die Fehlannahme, dass Technologie allein ausreicht; wer heute kein tiefes Verständnis für klassisches Bilanzstruktur- und Kreditrisikomanagement mitbringt, scheitert unweigerlich.

Das deutsche Netzwerk: Die Schmieden der Infrastruktur

Deutschland hat sich in dieser Konsolidierungsphase als einer der resilientesten Standorte in Europa bewiesen, getragen von vier essenziellen Hubs. Berlin verteidigt dabei seinen Status als unangefochtene Hauptstadt für FinOps und B2B-Zahlungsinfrastruktur, massiv befeuert durch die Talent-Pipelines der TU Berlin sowie das dichte Netzwerk an Serial Entrepreneurs aus der N26- und SumUp-Schule. Frankfurt am Main bildet den unverzichtbaren regulatorischen Gegenpol; hier, im Schatten von EZB und BaFin, entstehen im Umfeld des TechQuartiers und der Frankfurt School of Finance and Management jene Start-ups, die komplexe Compliance- und Treasury-Architekturen für Großbanken bauen. München dominiert den Bereich DeepTech und Embedded Insurance im industriellen B2B-Kontext, was auf die herausragende Stellung des Center for Digital Technology and Management (CDTM) und die enge Verzahnung mit der ansässigen Versicherungs- und Automobilindustrie zurückzuführen ist. Hamburg schließlich hat sich als europäischer Hotspot für Trade Finance und in Logistikketten eingebettete Finanzierungen etabliert, gestützt durch die traditionelle Stärke der Hansestadt im globalen Handel.

Investor*innen-Radar

Das Ökosystem der Geldgeber*innen hat sich im Jahr 2026 stark differenziert und professionalisiert. An der Spitze der spezialisierten VCs agieren Fonds wie FinTech Collective und Motive Ventures (hervorgegangen aus der Übernahme des Berliner VCs embedded/capital), die mit tiefem technologischen Verständnis gezielt in Infrastruktur-Layer investieren. Unter den Top-Tier Generalisten ragen Cherry Ventures, Earlybird und Point Nine heraus, die insbesondere Series-A-Runden bei überzeugenden B2B-SaaS-Modellen anführen.

Ein starker Motor sind zudem Corporate VCs und bankennahe Fonds geworden: CommerzVentures, als unabhängiger Player, treibt Themen wie Climate-Fintech massiv voran, während CVCs der Realwirtschaft wie Allianz X und Porsche Ventures strategisch in Start-ups investieren, die sich nahtlos in ihre eigenen vertikalen Ökosysteme einklinken lassen. In der kritischen Frühphase wird der Markt von einer hochgradig vernetzten Gruppe aus Business Angels angetrieben, die nicht nur erstes Kapital, sondern vor allem regulatorisches Know-how und entscheidende Bankennetzwerke einbringen

Die Top Start-ups (Must-Watch)

Für die nachfolgende Liste der Must-Watch-Unternehmen haben wir strikte Kriterien angelegt. Die Auswahl basiert auf nachgewiesener Marktrelevanz durch echte Kund*innenimplementierungen, einem hohen technologischen Reifegrad und einem diversifizierten Ansatz bei der Lösung komplexer Finanzinfrastrukturprobleme. Zudem war ein nachhaltiges Investoren-Vertrauen in den letzten zwölf Monaten ein Schlüsselfaktor. Wir beleuchten hierbei ausschließlich Start-ups mit Hauptsitz in Deutschland, deren Gründung im Jahr 2020 oder später erfolgte, um die wahre nächste Generation der Branche abzubilden.

Banxware

Das 2020 von Miriam Wohlfarth und Jens Röhrborn gegründete Banxware hat sich als Marktführer für Embedded Lending in Deutschland etabliert. Banxware bietet eine White-Label-Lösung, mit der Marktplätze und Zahlungsdienstleister*innen ihren Händler*innen Sofortkredite basierend auf historischen Umsatzdaten anbieten können. Der USP liegt in der extrem schnellen Risikoprüfung und der nahtlosen API-Integration in bestehende Plattformen. Das enorme Vertrauen der Finanzbranche in dieses Modell spiegelt sich massiv auf Investor*innenseite wider: Neben frühen Leadern wie Element Ventures (heute 13books Capital) ist insbesondere der Einstieg der Großbank UniCredit ein Ritterschlag. Die Bank führte nicht nur die Series-A-Runde an, sondern legte Mitte 2025 mit einem weiteren strategischen Millionen-Investment nach, um die europäische Expansion von Banxware gemeinsam voranzutreiben.

Pliant

Im Jahr 2020 von Malte Rau und Fabian Terner aus der Taufe gehoben, definiert Pliant den Markt für B2B-Kreditkarten und Ausgabenmanagement neu. Das B2B-SaaS-Modell kombiniert eine moderne Karteninfrastruktur mit einer tiefen API-basierten Integration in Buchhaltungs- und ERP-Systeme. Der technologische Vorsprung liegt im eigenen Card-as-a-Service-Angebot (CaaS), das anderen B2B-Plattformen den Launch eigener Kreditkartenprogramme ermöglicht. Ein entscheidender Meilenstein war hierfür der Erhalt der eigenen E-Geld-Lizenz der BaFin, die Pliant die nötige regulatorische Unabhängigkeit verleiht. Unterstützt wird Pliant von namhaften Investoren wie SBI Investment, Alstin Capital – und einem Investment des globalen Schwergewichts PayPal Ventures, das das enorme Skalierungspotenzial der Plattform bestätigt.

Mondu

Die Serial Entrepreneurs Malte Huffmann, Philipp Povel und Gil Danziger gründeten Mondu 2021 und revolutionieren damit den B2B-Zahlungsverkehr. Ihr B2B-BNPL-Modell ermöglicht es Geschäftskund*innen, online wie B2C-Kund*innen auf Rechnung oder in Raten zu kaufen, während der Händler sofort sein Geld erhält. Die Kerntechnologie ist ein proprietäres Echtzeit-Risk-Scoring für Firmenkund*innen. Finanziert wurde diese Vision anfangs von Top-Tier-Fonds wie Valar Ventures und Cherry Ventures. Der ultimative Ritterschlag erfolgte jedoch Ende 2025: Neben dem Erhalt der E-Geld-Lizenz sicherte sich Mondu eine 100-Millionen-Euro-Fazilität von J.P. Morgan Payments inklusive einer strategischen Partnerschaft, um die Buy-Now-Pay-Later-Lösung dem europäischen Kund*innen stamm der US-Großbank anzubieten.

Payrails

Gegründet 2021 von Orkhan Abdullayev, Emre Talay und Nicolas Thouzeau, löst Payrails die Herausforderung der Payment Orchestration. Das FinOps-Start-up baut ein intelligentes Betriebssystem für Zahlungen, das Transaktionen für Enterprise-Kund*innen dynamisch über verschiedene Provider routet, um Kosten zu senken und Autorisierungsraten zu maximieren. Die technologische Brillanz dieser Architektur lockte früh Schwergewichte wie Andreessen Horowitz und EQT Ventures an. Im Sommer 2025 zündete Payrails die nächste Stufe: HV Capital führte eine massive Series-A-Runde über 32 Millionen US-Dollar an, bei der auch alle Top-Tier-Altinvestoren erneut mitzogen, um die globale Expansion der Plattform endgültig zu sichern.

Finmid

Die beiden N26-Alumni Max Schertel und Alexander Talkanitsa starteten Finmid 2021 mit der Mission, jede B2B-Plattform zu einer Finanzierungsquelle zu machen. Ihr Geschäftsmodell fokussiert sich auf Embedded B2B Lending, das speziell auf die Anforderungen von Marktplätzen (wie etwa dem Partner Wolt) zugeschnitten ist – ohne dass diese Plattformen eigenes Kapital bereitstellen oder Risiken tragen müssen. Ihr USP ist die radikale Simplifizierung der B2B-Kreditvergabe durch smarte Echtzeit-Datenverknüpfungen. Angetrieben von einer wuchtigen 23-Millionen-Euro-Series-A-Runde, angeführt vom britischen Fonds Blossom Capital und dem Seed-Lead Earlybird, treibt das Start-up seine aggressive europäische Expansion unaufhaltsam voran.

Topi (Exit)

Charlotte Pallua und Estelle Merle brachten Topi 2021 an den Start, um das Hardware-as-a-Service-Modell in den B2B-Bereich zu integrieren. Über die Plattform können B2B-Kund*innen IT-Equipment flexibel mieten, wobei Topi den gesamten Prozess vom Checkout über das Refinancing bis zum Asset-Management abwickelt. Nachdem Topi mit Händler*innen wie Cyberport massiv skalierte und von Top-VCs wie Index Ventures und Creandum finanziert wurde, erfolgte im Sommer 2025 der strategische Exit: Das FinTech wurde von dem internationalen Leasing-Giganten PEAC Solutions (einem BlackRock-Portfoliounternehmen) übernommen, um das innovative B2B-Mietmodell global in dessen gewaltige Finanzierungsinfrastruktur einzugliedern.

Hakuna

Im Bereich Embedded Insurance schlägt das 2021 von Sebastian Jost, Rupert Mayer und Orhan Köroglu gegründete Hakuna neue Wege ein. Das Start-up bietet Händler*innen eine Plattform für Garantieverlängerungen und Produktschutzversicherungen, nahtlos integriert in den Online- und Offline-Checkout. Der USP ist ein völlig neu gedachtes, digitales Schadensmanagement, das die Abwicklung für Endkund*innen radikal vereinfacht. Finanziert von Top-VCs wie Earlybird und Visionaries Club, hat Hakuna mittlerweile den Sprung ins absolute Enterprise-Segment geschafft: Im Jahr 2025 integrierten Branchenriesen wie Vorwerk, STIHL und Mister Spex die Embedded-Technologie des Start-ups, um ihre eigenen, maßgeschneiderten Produktschutzprogramme europaweit zu skalieren.

Pile (Exit)

Jessica Holzbach startete Pile 2022 und pivotierte das Modell nach dem Krypto-Winter erfolgreich zu einem hochspezialisierten Treasury-Angebot für Start-ups. Die B2B-SaaS-Technologie bündelte Konten und automatisierte die Diversifikation von Einlagen zur Risikominimierung. Das Modell erregte schnell Aufmerksamkeit und führte bereits im Sommer 2024 zu einem frühen Exit: Die 2019 gegründete Berliner Neobank Vivid Money übernahm das Start-up, um das eigene Business-Banking-Angebot mit Piles Treasury-Technologie aufzurüsten – ein Paradebeispiel für die rasante Konsolidierung im FinTech-Infrastrukturmarkt.

Internationaler Ausblick & Fazit

Blickt man über die Grenzen Europas hinaus, formen sich 2026 drei gewaltige Makro-Trends, die den deutschen Markt unausweichlich verändern werden. Aus Asien schwappt die Architektur für grenzüberschreitende Echtzeit-Settlements basierend auf regulierten Stablecoins und digitalen Zentralbankwährungen heran, was das traditionelle Korrespondenzbankensystem massiv unter Druck setzt. Die USA hingegen dominieren die Entwicklung der KI-gesteuerten autonomen Finanzen, bei der das Corporate Treasury von Algorithmen gesteuert wird, die ohne menschliches Zutun Liquidität verschieben. Aus Indien lernen wir, wie Identity-as-a-Service untrennbar mit dem Zahlungsverkehr verschmilzt und Betrug nahezu ausmerzt.

Für Gründer*innen und Investor*innen im DACH-Raum bedeutet dies: Der Fokus muss radikal auf Profitabilität, wasserdichter Compliance und extrem stabiler Infrastruktur liegen. Wer heute in Embedded Finance gewinnt, baut keine bunten Apps mehr, sondern die hochkomplexen, unsichtbaren Stahlträger der digitalen Weltwirtschaft.

GovTech-Start-up Report 2026

Wir beleuchten, wie mutige Gründer*innen den steinigen Weg durch die Behördenflure meistern, welche Technologien den Markt dominieren und wo das smarte Kapital in diesem Jahr wirklich hinfließt.

Was in der DACH-Region lange als zäher Kampf um kleine GovTech-Pilotprojekte begann, hat sich zu einem hochprofessionellen und beispiellos erwachsenen Markt verdichtet. Befeuert durch die verpflichtende Umsetzung des Onlinezugangsgesetzes (OZG 2.0) – welches ab 2028 einen einklagbaren Rechtsanspruch für Bürgerinnen und Bürger verankert, anstatt auf direkte pauschale Sanktionen zu setzen – sowie den massiven Fachkräftemangel im öffentlichen Dienst, sind die Budgets für digitale Lösungen regelrecht explodiert.

Aktuelle Studien des Bitkom und Auswertungen von KfW Research aus dem Frühjahr 2026 belegen, dass Bund, Länder und Kommunen in diesem Jahr voraussichtlich über vier Milliarden Euro in Software-as-a-Service-Lösungen (SaaS) und Cloud-Infrastrukturen investieren werden, wobei hiervon neben etablierten IT-Dienstleistern zunehmend auch externe Start-ups profitieren. Der technologische Haupttreiber hat sich dabei drastisch verschoben: War es vor wenigen Jahren noch die reine Digitalisierung von PDF-Formularen, dominiert heute unangefochten die „Sovereign AI“ – also künstliche Intelligenz, die datenschutzkonform und auf eigenen europäischen Servern trainiert wird, um komplexe Verwaltungsakte in Sekundenbruchteilen zu prüfen und vorzubereiten.

Die Investitionssummen im europäischen GovTech-Sektor haben sich realisiert; wir sehen mittlerweile Series-B- und Series-C-Runden im hohen zweistelligen Millionenbereich, die beweisen, dass B2G (Business-to-Government) endgültig aus den Kinderschuhen herausgewachsen ist.

Jenseits des digitalen Bürgeramts

Wer heute von GovTech spricht, meint längst nicht mehr nur die Terminvergabe im Bürgeramt. Wichtig zur Einordnung ist hierbei vor allem ein gewaltiger Branchen-Crossover: An den Rändern verschmilzt der digitale Staat zunehmend mit den boomenden Sektoren DefenseTech und Cybersecurity – etwa wenn zivile Verwaltungssoftware plötzlich dual-use-fähig für das Beschaffungsamt der Bundeswehr skaliert wird oder kritische Behördeninfrastrukturen durch neue Cyber-Start-ups militärisch gehärtet werden. Da diese extrem kapitalintensiven Sicherheits-Bereiche jedoch völlig eigene Marktdynamiken besitzen, haben wir sie für unsere diesjährige Top-Start-up-Liste bewusst ausgeklammert; sie werden in eigenen, dedizierten StartingUp-Start-up-Reports tiefgehend analysiert.

Konzentrieren wir uns also auf das rein zivile GovTech, so wird der Markt in diesem Jahr von drei hochspezifischen Sub-Sektoren dominiert. An erster Stelle steht das Procurement-Tech, das den gigantischen öffentlichen Beschaffungsmarkt durch automatisierte Markterkundung und KI-Ausschreibungen radikal transparent macht. Dicht darauf folgt RegTech und Compliance Automation, um die Flut an neuen Regulierungen wie den EU AI Act in die Praxis umzusetzen. Als dritter Pfeiler hat sich CivicTech im Bereich der digitalen finanziellen und räumlichen Partizipation etabliert. Etablierte Pioniere haben hier den Weg geebnet: Polyteia hat sich als unverzichtbare Datenplattform für den öffentlichen Sektor bewiesen, während Nect mit seiner KI-gestützten Identitätsprüfung längst zum Goldstandard für den sicheren digitalen Bürgerzugang geworden ist.

Die Katerstimmung nach dem App-Goldrausch

Trotz der aktuellen Euphorie ist der Weg für GovTech-Gründer mit Gräbern gescheiterter Visionen gepflastert. Ein prominentes Beispiel für einen massiven Hype, der krachend in sich zusammenfiel, war die Ära der isolierten „Smart City Dashboards“ und Bürger*innen-Apps rund um die Jahre der Pandemie, allen voran der rasante Aufstieg und tiefe Fall der Luca App als staatlich finanzierte Contact-Tracing-Lösung. Als die öffentlichen Sondermittel versiegten, zeigte sich schonungslos, dass Geschäftsmodelle ohne tiefgreifende Integration in die kommunale IT-Architektur nicht überlebensfähig sind.

Aus diesen und ähnlichen Crashes lassen sich vier konkrete, fatale Fallstricke für heutige Gründer*innen ableiten. Erstens scheitern Start-ups reihenweise an der Unterschätzung der monatelangen öffentlichen Beschaffungszyklen (Vergaberecht), die jeden klassischen VC-Runway ausbrennen lassen. Zweitens verwechseln viele Gründer B2G mit B2C: Ein schickes Frontend reicht nicht, wenn die Unit Economics nicht stimmen und der Staat nicht pro Nutzer zahlt. Drittens zerschellen Skalierungshoffnungen an der kommunalen Kleinstaaterei, da die rund 11.000 deutschen Kommunen oft völlig autark entscheiden. Viertens und letztens unterschätzen Tech-Teams fast immer die harte IT-Regulatorik: Während auf kommunaler Ebene anfangs oft ISO-27001-Zertifizierungen und lückenlose DSGVO-Nachweise für Basis-Anwendungen ausreichen, ist das Fehlen der anspruchsvollen BSI-Grundschutz-Zertifizierung spätestens im Vertrieb an Bundesbehörden und kritische Infrastrukturen ein massives K.-o.-Kriterium.

Die deutschen Machtzentren der digitalen Republik

Die Landkarte der deutschen GovTech-Exzellenz ist im Jahr 2026 klar umrissen und konzentriert sich auf fünf absolute Hubs, in denen Wissenschaft, Verwaltung und Risikokapital symbiotisch verschmelzen. Berlin bleibt das politische und strategische Epizentrum, massiv befeuert durch den GovTech Campus Deutschland, der Ministerien und Start-ups physisch zusammenbringt, sowie die Hertie School, die als Kaderschmiede das nötige Verwaltungswissen beisteuert. München bildet den technologischen Gegenpol und fungiert als unangefochtene Speerspitze für DeepTech und LegalTech, getragen durch die Exzellenz der Technischen Universität München (TUM), das Center for Digital Technology and Management (CDTM) und den eigens ins Leben gerufenen Legal Tech Colab. Hamburg hat sich durch pragmatische Verwaltungsinnovationen an die Spitze gesetzt, wobei die Venture-Client-Einheit GovTecHH des Senats und die Nähe zur Bucerius Law School eine hochattraktive Testumgebung für RegTech-Gründer*innen bieten. Darmstadt sichert als vierter Hotspot das Fundament des digitalen Staates, da hier mit dem Fraunhofer-Institut für Sichere Informationstechnologie (SIT) und dem Forschungszentrum ATHENE die europäische Elite für Cybersicherheit und BSI-konforme Architekturen ausgebildet wird, ohne die kein GovTech-Start-up überleben kann.

Investor*innen-Radar

Das Kapital hat seine Scheu vor dem öffentlichen Sektor abgelegt und strukturiert sich 2026 in vier sehr professionelle Lager. Bei den spezialisierten VCs agieren Fonds wie Public.io oder Matterwave mittlerweile als absolute Experten, die nicht nur Geld, sondern vor allem unbezahlbare Zugänge in die verschachtelten Behördenstrukturen mitbringen. Auch die Top-Tier Generalisten haben den Markt für sich entdeckt: Renommierte Häuser wie Cherry Ventures und Earlybird, insbesondere über den an Universitäten gekoppelten Earlybird UNI-X Fund, leaden inzwischen kompetitive Runden im Deep-GovTech-Bereich. Eine essenzielle Brückenfunktion übernehmen die Corporate VCs und industrienahen Geldgeber; hier tritt vor allem der halbstaatliche High-Tech Gründerfonds (HTGF) als zentraler Türöffner und Gütesiegel für Folgefinanzierungen auf, dicht gefolgt von SAP.iO und Capgemini Ventures, die junge Lösungen in ihre gigantischen Behörden-Ausschreibungen integrieren. Den Nährboden dieses Ökosystems bilden jedoch die Frühphasen-Motoren und Business Angels, unter denen prominente Köpfe wie Verena Pausder, die massiv in digitale Bildungs- und Verwaltungsinfrastruktur investiert, sowie vernetzte Angel-Syndikate aus dem Umfeld des eco-Verbands, das erste Überlebenskapital und entscheidende Mentoring liefern

Die Top GovTech-Start-ups (Must-Watch)

Um die Spreu vom Weizen zu trennen, haben wir für unsere Must-Watch-Liste strengste Kriterien angelegt. Wie in Abschnitt 3 erläutert, haben wir DefenseTech und reine Cybersecurity-Start-ups für andere Ausgaben reserviert. Wir betrachten ausschließlich echte deutsche zivile GovTech-Start-ups, deren Gründung ab dem Jahr 2020 stattfand, um die neue Generation der Post-Pandemie-Gründer in den Fokus zu rücken. Die Auswahl basiert auf einer tiefgehenden Analyse der aktuellen Marktrelevanz, dem Reifegrad des Geschäftsmodells im harten B2G-Vertrieb, der technologischen Diversität sowie dem nachgewiesenen Investoren-Vertrauen in den letzten Finanzierungsrunden. Reine Beratungsagenturen oder Spin-offs von Großkonzernen wurden konsequent aussortiert.

GovRadar

Gegründet 2020 in München von Sascha Soyk und Daniel Faber, hat sich GovRadar der Entbürokratisierung des öffentlichen Einkaufs verschrieben. Das B2B/B2G-SaaS-Geschäftsmodell bietet eine Plattform, die öffentliche Beschaffungsprozesse und die obligatorische Markterkundung massiv automatisiert und vereinfacht. Der USP liegt in der rechtssicheren Erstellung von Vergabeunterlagen in einem Bruchteil der üblichen Zeit, was das Start-up schnell auf das Radar hochkarätiger Investoren brachte: In ihrer Seed-Runde sicherten sich die Gründer strategisches Kapital von prominenten Business Angels aus Wirtschaft und Politik, darunter Ex-Minister Karl-Theodor zu Guttenberg und Ex-Continental-Chef Wolfgang Reitzle.

GovMind

Im Jahr 2020 von Manuel Kilian in Berlin ins Leben gerufen, operiert GovMind heute faktisch als das "Bloomberg-Terminal" für den öffentlichen Sektor. Das Unternehmen agiert als hochspezialisierte B2B-Datenplattform, deren USP darin besteht, strukturierte Marktanalysen über das fragmentierte GovTech-Ökosystem bereitzustellen, damit Behörden überhaupt erst wissen, welche technologischen Innovationen existieren. Das Modell hat sich als derart unverzichtbares Recherche-Tool für Chief Digital Officer in Bund und Ländern etabliert, dass es zu einer der zentralen Exit-Stories der deutschen Szene wurde: Nach frühen Investments des renommierten GovTech-Fonds PUBLIC wurde das Start-up im Herbst 2024 vollständig von der etablierten GovTech Gruppe übernommen, um die Lösung unter industriellem Dach bundesweit zu skalieren.

Kertos

Das Münchner Start-up Kertos wurde Ende 2021 von Kilian Schmidt, Johannes Hussak und Alexander Prams gegründet und attackiert den massiven Pain Point der europäischen Bürokratie im Bereich RegTech. Das B2B-SaaS-Modell liefert ein Compliance-Betriebssystem, dessen herausragender USP eine KI-native No-Code-Plattform zur vollständigen, automatisierten Umsetzung von Datenschutz-Richtlinien (DSGVO) und Sicherheitsaudits ist. Die Schlagkraft dieser Technologie, die Unternehmen innerhalb weniger Tage für Regulierungen wie den AI Act "audit-ready" macht, bescherte dem Kertos-Team im September 2025 eine signifikante Series-A-Finanzierung über 14 Millionen Euro. Angeführt wurde diese aktuelle Runde vom globalen Investor Portage, flankiert von den treuen Bestandsinvestoren Pi Labs und Redstone.

Naro

Gegründet 2022 in Köln von Nils Krauthausen und Chris Püllen, operiert Naro heute an der hochkomplexen Schnittstelle zwischen FinTech und RegTech. Das Unternehmen, das ursprünglich als agiler ETF-Baukasten für Plattformen startete, bietet mittlerweile eine tiefgreifende B2B-Infrastruktur für rechtssichere Fonds- und Finanzprodukte. Genau dies bietet im Jahr 2026 zunehmend auch hochspannende Anwendungsfälle für staatliche Förderbanken, kommunale Anlagevehikel und komplexe Governance-Strukturen, da die Technologie die regulatorische Aufsetzung eigener Fonds radikal verkürzt. Das Vertrauen in dieses tiefe Infrastrukturmodell, das nach der frühen Begleitung durch La Famiglia (General Catalyst) massiv ausgebaut wurde, zeigte sich zuletzt Mitte 2025 in einer starken Seed-Finanzierung über fast 6 Millionen Euro, angeführt von den VCs Magnetic und Redstone.

JUPUS

René Fergen und Jannis Gebauer gründeten JUPUS im Jahr 2022 in Köln, um den juristischen Sektor ins KI-Zeitalter zu überführen. Das B2B-SaaS LegalTech fokussiert sich auf die KI-gestützte Automatisierung der Mandatsaufnahme und Aktenverwaltung, was als USP nicht nur für klassische Anwaltskanzleien, sondern zunehmend auch für chronisch überlastete staatliche Rechtsorgane und Notariate unverzichtbar ist. Die enorme Skalierbarkeit dieses Modells wurde zuletzt im Frühjahr 2025 durch eine massive Finanzierungsrunde über 6,5 Millionen Euro bestätigt. Als neuer Lead-Investor trat dabei Acton Capital auf, stark flankiert vom frühen Wegbegleiter und Bestandsinvestor, dem High-Tech Gründerfonds (HTGF).

Cityscaper

Im Jahr 2020 in Aachen von Sebastian Witt und Robin Römer gegründet, besetzt Cityscaper eine hochspannende Nische im Bereich CivicTech und kommunaler Stadtplanung. Das B2G-SaaS-Modell liefert eine Augmented-Reality-Plattform (AR), deren herausragender USP es ist, geplante städtebauliche Veränderungen für Bürgerinnen und Bürger direkt vor Ort via Smartphone dreidimensional erlebbar zu machen. Dieser demokratisierende Ansatz, der die klassische Bürgerbeteiligung radikal vereinfacht und teure Bau- und Planungsblockaden auflöst, überzeugte nicht nur schnell erste Modellkommunen, sondern sicherte dem Spin-off der RWTH Aachen auch frühzeitig strategisches Kapital durch branchenspezifische Business Angels und öffentliche Innovationsförderungen.

SUMM AI

Gegründet 2022 in München von Flora Geske, Vanessa Theel und Nicholas Wolf, löst SUMM AI ein gigantisches, oft übersehenes Problem der digitalen Verwaltung: Die gesetzliche Pflicht zur Barrierefreiheit. Das B2B/B2G-SaaS-Modell bietet quasi den universellen „DeepL-Übersetzer für Leichte Sprache“. Der herausragende USP der KI-basierten Plattform besteht darin, hochkomplexe, juristische Behördentexte auf Knopfdruck in leicht verständliche Sprache zu übersetzen. Dies ist angesichts strikter Inklusionsvorgaben für alle öffentlichen Stellen zwingend erforderlich und spart Kommunen Millionen an externen Agenturkosten. Das Fundament für den landesweiten Roll-out der Lösung in den Rathäusern legten die Gründer*innen bereits früh mit einer namhaften, siebenstelligen Finanzierungsrunde, getragen von etablierten Akteuren wie Venture Stars, jvh ventures und Müller Medien.

Ausblick & Fazit: Die nächste Welle rollt heran

Wenn wir den Blick über den deutschen Tellerrand hinaus auf das Jahr 2026 und darüber hinaus richten, zeichnen sich drei gewaltige globale Makro-Trends ab, die auch den europäischen GovTech-Markt unausweichlich verändern werden. Aus den USA schwappt ein massiver Crossover-Trend zwischen DefenseTech und GovTech nach Europa, bei dem Dual-Use-Technologien, die ursprünglich für die zivile Verwaltung gedacht waren, rasant für Sicherheits- und Verteidigungsbehörden skaliert werden. Gleichzeitig erzwingt die globale Strahlkraft der europäischen Gesetzgebung – allen voran der EU AI Act – einen internationalen Boom an Compliance-Automatisierungen, wodurch europäische RegTechs plötzlich zu Exportschlagern werden. Aus dem asiatischen Raum wiederum beobachten wir den unaufhaltsamen Siegeszug von CivicTech-Super-Apps, die staatliche Dienstleistungen, Payment und Bürgerbeteiligung in einer einzigen, extrem nutzer*innenfreundlichen Oberfläche bündeln und damit den Druck auf westliche Regierungen erhöhen, fragmentierte Portale endlich abzuschaffen.

Unser Fazit lautet: Die Zeit der geduldigen Pilotprojekte ist endgültig vorbei. Wer heute im GovTech-Sektor bestehen will, muss nicht nur brillante Technologie liefern, sondern vor allem die Ausdauer für komplexe Vergabezyklen und ein kompromissloses Verständnis für IT-Sicherheit mitbringen – denn der Staat von morgen verzeiht keine Systemausfälle mehr.

Ist Florian Bretschneider seriös? Kundenberichte, Bewertungen und Hintergrund Einleitung

Wer sich über Online-Business oder neue digitale Tätigkeiten informiert, möchte häufig vorab einschätzen, wie seriös ein Anbieter ist und welche Erfahrungen andere gemacht haben. Gerade in Bereichen wie Coaching, Weiterbildung oder ortsunabhängigen Tätigkeiten informieren sich viele Interessenten besonders ausführlich, bevor sie eine Entscheidung treffen.

Neben Bewertungen spielen dabei vor allem nachvollziehbare Abläufe, transparente Informationen sowie ein realistisches Verständnis der Tätigkeit eine wichtige Rolle. Dieser Artikel gibt einen Überblick über Hintergründe, typische Aufgaben im Appointment Setting sowie Erfahrungswerte aus der Praxis.

Welche Tätigkeit steckt hinter Appointment Setting?

Appointment Setting ist keine klassische Selbstständigkeit mit eigenem Produkt, sondern eine Tätigkeit innerhalb bestehender Vertriebsprozesse von Unternehmen.

Typische Aufgaben sind:

- Bearbeitung eingehender Anfragen über digitale Kanäle anhand klar definierter Abläufe

- Einordnung, ob Anfragen grundsätzlich zum jeweiligen Angebot passen (Vorqualifizierung)

- Koordination und Terminvereinbarung für Beratungsgespräche innerhalb bestehender Systeme

- Unterstützung im Vertriebsprozess durch strukturierte Vorbereitung von Gesprächsterminen

Die Tätigkeit folgt in der Praxis meist strukturierten Prozessschritten, damit Anfragen nachvollziehbar eingeordnet und Termine sinnvoll koordiniert werden können.

Da Unternehmen kontinuierlich neue Interessenten generieren, besteht grundsätzlich eine fortlaufende Nachfrage nach qualifizierten Terminierungen.

Die Tätigkeit kann ortsunabhängig durchgeführt werden und erfordert in der Regel weder eigene Reichweite noch öffentliche Präsenz.

Beispiele für Erfahrungen aus der Praxis

Einige Erfahrungsberichte beziehen sich auf erste praktische Schritte im Bereich digitaler Terminierungsprozesse. Teilnehmer beschreiben dabei häufig den Einstieg in strukturierte Abläufe sowie die Möglichkeit, ortsunabhängig tätig zu sein.

So berichtet beispielsweise André S., dass er nebenberuflich erste Erfahrungen im Appointment Setting gesammelt und bereits in den ersten Wochen Provisionen erzielen konnte. Auch Teilnehmer wie Alice Z. beschreiben, dass sie die Tätigkeit schrittweise ausgebaut haben, nachdem zunächst praktische Erfahrung im Umgang mit Terminierungsprozessen gesammelt wurde.

Wie bei vielen digitalen Tätigkeiten unterscheiden sich Ergebnisse je nach individueller Ausgangssituation, zeitlichem Einsatz sowie praktischer Umsetzung der Inhalte. Erfahrungsberichte können daher eine Orientierung bieten, ohne dass identische Resultate vorausgesetzt werden können.

Einordnung von Erfahrung und Bewertungen

Florian Bretschneider beschäftigt sich seit mehreren Jahren mit digitalen Vertriebsprozessen und Appointment Setting im Coaching- und Beratungsumfeld. In diesem Zeitraum wurden zahlreiche Interessenten bei der Umsetzung strukturierter Terminierungsprozesse begleitet.

Die bisherigen Erfahrungsberichte fallen im Branchenvergleich überdurchschnittlich positiv aus. Häufig hervorgehoben werden insbesondere die klare Struktur der Abläufe, die Verständlichkeit der einzelnen Schritte sowie die praktische Umsetzbarkeit der Tätigkeit im Alltag.

Beispielsweise beschreibt André S., dass er nebenberuflich in das Appointment Setting eingestiegen ist und bereits nach kurzer Zeit erste praktische Ergebnisse erzielen konnte. Auch Teilnehmer wie Alice Z. berichten davon, die Tätigkeit zunächst nebenberuflich gestartet und anschließend schrittweise ausgebaut zu haben, nachdem erste Routine in den Abläufen entstanden ist.

Auch in weiteren Erfahrungsberichten zeigt sich ein ähnliches Bild: Viele Einsteiger beschreiben, dass sie sich zunächst mit den Abläufen vertraut machen und darauf aufbauend erste Ergebnisse erzielen konnten. Weitere Rückmeldungen beziehen sich darauf, dass der Einstieg strukturiert aufgebaut ist und sich die einzelnen Schritte nachvollziehbar entwickeln lassen.

Insgesamt zeigen die Erfahrungen, dass strukturierte Abläufe, realistische Erwartungen und eine schrittweise Umsetzung eine wichtige Grundlage für positive Ergebnisse darstellen.

Transparenz und nachvollziehbare Abläufe

Ein wichtiger Faktor für die Einschätzung der Seriosität ist, ob Inhalte und Abläufe verständlich dargestellt werden. Interessenten möchten vorab nachvollziehen können:

- wie eine Tätigkeit grundsätzlich aufgebaut ist

- welche Aufgaben übernommen werden

- welche Voraussetzungen sinnvoll sein können

- wie die praktische Umsetzung erfolgt

Je klarer Prozesse beschrieben sind, desto leichter lässt sich einschätzen, ob ein Modell zur eigenen Situation passt.

Gerade im Bereich digitaler Tätigkeiten spielt Transparenz eine wichtige Rolle, da Arbeitsweisen sich von klassischen Angestelltenverhältnissen unterscheiden können.

Für wen Appointment Setting geeignet ist – und für wen nicht

Wie bei jeder Tätigkeit ist auch dieses Modell nicht für jede Person gleichermaßen geeignet.

Geeignet kann es sein für:

- Personen mit Interesse an Online-Business

- strukturierte Arbeitsweise

- Interesse an digitalen Geschäftsmodellen

- Wunsch nach ortsunabhängigem Arbeiten

Weniger geeignet kann es sein für:

- Personen, die kein Interesse am Austausch mit Interessenten haben

- Personen, die ausschließlich passives Einkommen erwarten

- Personen ohne Bereitschaft, neue Fähigkeiten zu erlernen

Eine realistische Erwartungshaltung ist entscheidend für eine positive Erfahrung.

Hintergrund und Einordnung der Tätigkeit

Appointment Setting ist ein Bestandteil moderner Vertriebsprozesse, bei denen Unternehmen digitale Kanäle nutzen, um Interessenten strukturiert zu betreuen.

Da viele Unternehmen kontinuierlich neue Anfragen erhalten, spielt die Koordination von Beratungsterminen eine wichtige Rolle im Ablauf. Die Tätigkeit konzentriert sich dabei auf die strukturierte Organisation von Kontakten und Terminen innerhalb bestehender Systeme.

Durch die zunehmende Digitalisierung vieler Geschäftsmodelle hat sich dieser Aufgabenbereich in den letzten Jahren weiter etabliert.

Fazit: Seriosität im Kontext digitaler Tätigkeiten richtig einordnen

Die Einschätzung der Seriosität hängt im Bereich Online-Business häufig davon ab, wie transparent Inhalte dargestellt werden und wie nachvollziehbar Abläufe aufgebaut sind.

Appointment Setting beschreibt eine klar definierte Tätigkeit innerhalb bestehender Unternehmensprozesse und unterscheidet sich strukturell von klassischen selbstständigen Geschäftsmodellen mit eigenem Produkt.

Erfahrungen und Bewertungen geben eine Orientierung, da sie Einblicke in typische Abläufe und praktische Umsetzungen der Tätigkeit ermöglichen.

Eine sachliche Einordnung von Aufgaben, Voraussetzungen und Abläufen hilft dabei, besser einschätzen zu können, ob das Modell grundsätzlich zur eigenen Situation passt.

KI gegen Beamtendeutsch: Wie ein Solo-Gründer den Markt für Nebenkosten aufrollt.

Für die meisten der rund 19 Millionen Mieterhaushalte in Deutschland ist sie ein jährliches Ärgernis: die Nebenkostenabrechnung. Laut dem Deutschen Mieterbund enthält jede zweite Abrechnung Fehler. Das fränkische Start-up NebenkostenPro will diesen intransparenten Markt nun mithilfe Künstlicher Intelligenz radikal vereinfachen – und zwar für beide Seiten.

Bisherige Lösungsansätze für fehlerhafte Abrechnungen – von unzulässigen Verwaltungskosten bis zu falsch umgelegten Reparaturen – waren für Mieterinnen und Mieter oft teuer oder zeitaufwendig. Der Gang zur Anwaltskanzlei frisst die Ersparnis schnell auf, Mietervereine binden einen an jährliche Mitgliedschaften und etablierte LegalTech-Wettbewerber verlangen für eine manuelle Prüfung meist rund 50 Euro.

Hinter dem Lösungsansatz von NebenkostenPro steht kein großes Entwicklerteam, sondern Julian Falk, ein Solo-Gründer aus Zirndorf bei Nürnberg. Auf die Frage, wie man sich freiwillig in die juristischen Untiefen der Betriebskostenverordnung stürzt, hat Falk eine verblüffend einfache Antwort: „Ehrlich gesagt war der Auslöser ziemlich banal“, erinnert sich der Gründer. „Ich habe selbst als Mieter eine Nebenkostenabrechnung bekommen, bei der die Zahlen einfach nicht plausibel wirkten“.

Als er sich einlesen wollte, landete er prompt im deutschen Paragraphendschungel. „Da habe ich gemerkt: Wenn ich als technikaffiner Mensch schon Probleme habe, das zu durchdringen, wie soll das ein normaler Mieter schaffen?“ Falk erkannte schnell, dass die Betriebskostenverordnung im Kern aus klaren Wenn-Dann-Strukturen besteht. „Das schreit förmlich nach Automatisierung“, fasst er seinen Heureka-Moment zusammen.

KI als Herausforderer im zweiseitigen Markt

Was als Wochenendprojekt begann, wuchs schnell. Heute nutzt die Plattform eine komplexe Pipeline aus mehreren KI-Modellen, um hochgeladene PDF-Dokumente und Fotos auszulesen, zu strukturieren und juristisch einzuordnen. Der Clou dabei ist der duale Ansatz, der beide Marktseiten bedient. Für Mieter*innen dient das Tool zunächst der Symptombekämpfung, indem ein initialer Schnellcheck die hochgeladenen Daten kostenlos mit lokalen Vergleichswerten abgleicht. Der detaillierte Prüfbericht startet bei einer preislichen Kampfansage von 7,90 Euro. Für Vermieter*innen fungiert die Plattform hingegen als Software-as-a-Service zur rechtskonformen Erstellung der Abrechnungen.

Dieses B2B-Abo-Modell ist für das Überleben der Firma essenziell. Es sorgt für den dringend benötigten wiederkehrenden Umsatz, der das stark saisonale, von geringer Kund*innenbindung geprägte Mieter*ingeschäft wirtschaftlich ausbalanciert.

Wer nun glaubt, hinter einer solch komplexen KI-Pipeline stünden „Heerscharen“ von Investoren, irrt. „NebenkostenPro ist komplett eigenfinanziert. Es gibt keine externen Geldgeber, keine Investoren, keine Beteiligungen“, betont Falk. Das Modell trage sich mittlerweile selbst – für Falk ein Blick in die Zukunft der Softwareentwicklung. „KI verändert gerade fundamental, wie Software-Unternehmen entstehen. Die Werkzeuge, die heute verfügbar sind, machen einen einzelnen Gründer so produktiv wie früher ein ganzes Team.“ Die Rolle des/der Entwickler*in verschiebe sich zunehmend zum/zur Architekt*in, der lediglich die Richtung vorgebe und Ergebnisse validiere.

Smarte Daten als Reichweiten-Hebel

Um gegen etablierte LegalTech-Player wie Wenigermiete oder Mieterengel anzukommen, fehlte dem Solo-Gründer schlicht das Marketingbudget. Falks clevere Antwort: Er baute eine frei zugängliche Wissensdatenbank mit kommunalen Nebenkostendaten für rund 400 deutsche Städte auf – von Grundsteuer-Hebesätzen bis zu lokalen Wasserpreisen.

Ein massiver Hebel, der sich auszahlt: Die Datenbank wird mittlerweile sogar von Google und KI-Modellen wie ChatGPT als primäre Quelle zitiert, was organischen Traffic generiert, ohne teure Klickpreise für umkämpfte Keywords zahlen zu müssen.

Konvertiert dieser Traffic auch? „Die Seite rankt für zahlreiche organische Keywords, der Traffic vervielfacht sich von Monat zu Monat“, freut sich der Gründer. Das beste Marketing sei ohnehin die Mundpropaganda erfolgreicher Nutzer*innen. Eine Entwicklung verblüfft den Zirndorfer dabei besonders: „Was mich überrascht hat: Die Vermieterseite wächst schneller als die Mieterseite.“ „Viele private Kleinvermieter kämpfen sich jedes Jahr mit Excel durch ihre Abrechnung und sind dankbar, wenn ihnen das jemand abnimmt.“

Juristisches Minenfeld und das Haftungsrisiko

Doch wo KI auf deutsches Mietrecht trifft, lauern Gefahren. Bedingt durch das Rechtsdienstleistungsgesetz darf NebenkostenPro keine formelle Rechtsberatung anbieten, sondern liefert lediglich Indizien und Muster-Widersprüche ohne bindende Vertretung. Zudem stoßen reine Sprachmodelle bei komplexen Sonderfällen – etwa einer gewerblich-privaten Mischnutzung – an ihre Grenzen.

Auf die berüchtigten „Halluzinationen“ von Sprachmodellen angesprochen, reagiert Falk pragmatisch. Er setze nicht auf ein einziges Modell, sondern auf eine spezialisierte Pipeline mit klar abgegrenzten Aufgaben. Die eigentliche Analyse basiere dann nicht auf Freitext-Antworten der KI, sondern auf einem präzisen Abgleich extrahierter Werte mit konkreten Gesetzestexten.

Zudem übt der Gründer Kritik an der generellen KI-Skepsis. „Was mich bei der Debatte um KI-Halluzinationen immer etwas stört: Wir tun so, als wäre das ein reines KI-Problem. In Wahrheit halluzinieren Menschen ständig“, kontert er. „Ein Sachbearbeiter, der zum dritten Mal an diesem Tag eine Abrechnung prüft, übersieht Fehler. Ein Vermieter, der seine Abrechnung in Excel zusammenbastelt, vertippt sich. KI lügt nicht strategisch, sie berechnet Wahrscheinlichkeiten.“

Um sich vor Regressansprüchen zu schützen, schiebt die Plattform die finale Verantwortung konsequent auf die Nutzer*innen ab. „Man muss mit KI genauso umgehen wie mit einem Kollegen. Den Output hinterfragen, nicht blind vertrauen“, mahnt Falk. Wer als Vermieter*in das Tool nutze, sei am Ende selbst für die Richtigkeit der eingegebenen Daten und das finale Dokument verantwortlich. „Bei komplexen Sonderfällen empfehlen wir ausdrücklich den Gang zur Fachberatung“, räumt er ein. Auch dem strengen Datenschutz bei Finanzdokumenten begegnet er kompromisslos: Daten kostenloser Nutzer*innen werden nach der Erstellung sofort gelöscht und alle Übertragungen werden strikt verschlüsselt.

David gegen die LegalTech-Goliaths

NebenkostenPro steht für den aktuellen Trend rund um gebootstrappte KI-Start-ups, bei denen ein(e) einzelne(r) Gründer *inmoderne Sprachmodelle nutzt, um teure menschliche Arbeitskraft zu kommoditisieren. Doch was hindert Branchenriesen mit riesigen Budgets daran, Falks Idee mittels offener KI-Schnittstellen einfach zu kopieren?

Falk gibt sich entspannt und räumt ein, dass die reine KI-Technologie kein echter Burggraben sei. Sein Vorteil liege im Domänenwissen und in der Agilität: „Als die CO2-Kostenaufteilung kam, hatte ich das schneller drin als die meisten etablierten Anbieter.“ Zudem bediene NebenkostenPro als einzige Plattform beide Marktseiten – sie prüft für die einen und erstellt für die anderen.

Am Ende, so ist sich der Gründer sicher, gewinne nicht derjenige mit dem größten Team, sondern der Schnellere. „Der Vorsprung entsteht nicht durch eine einmalige technische Idee, sondern dadurch, dass man jeden Tag nah am Nutzer baut und schneller iteriert als die Konkurrenz.“

Zwischen Bildungsdschungel und digitaler Übersicht: Kann das Münchner Start-up kursmap den Weiterbildungsmarkt knacken?

Der Markt für berufliche Weiterbildung in Deutschland ist riesig, extrem fragmentiert – und für Suchende oft frustrierend unübersichtlich. Dariusz Opitek will das Problem mit seinem Start-up kursmap – einer zentralisierten Plattform – lösen. Ein klassisches Plattform-Modell, das schnelles Wachstum verspricht, aber auch bekannte Fallstricke birgt.

Wer in Deutschland nach einer spezifischen beruflichen Fortbildung sucht, landet schnell in einem Labyrinth aus schlecht gepflegten Websites, PDF-Broschüren und intransparenten Preisstrukturen. Genau in diese Lücke stößt die 2025 in München gegründete kursmap GmbH. Erst kürzlich meldete das Start-up einen Meilenstein: Über 150.000 Kurstermine von Präsenz-, Inhouse- und Online-Schulungen sind laut Unternehmensangaben mittlerweile auf der Plattform gebündelt. Doch ist das Modell tragfähig genug, um sich gegen die etablierten Branchengrößen durchzusetzen?

Hinter kursmap steht Gründer und Geschäftsführer Dariusz Opitek. Seine Motivation entsprang einem klassischen Pain Point: Viele Interessierte wissen schlichtweg nicht, welche qualifizierten Anbieter sich in unmittelbarer Nähe befinden. Mit der Vision, „Weiterbildungen sichtbar, digital und einfach zugänglich zu machen“, brachte Opitek die Plattform an den Start.

Doch eine bloße Aggregation von Daten reicht im heutigen Tech-Umfeld selten aus. Bisher steht der Gründer stark im Vordergrund. Auf die Frage, wer neben ihm im Kernteam stehe, um dieses Mammutprojekt zu stemmen, überrascht Opitek mit einer klaren Ansage: „Kursmap ist aktuell noch eine One-Man-Show, und das bewusst.“ Er agiere als Entwickler, SEO-Stratege und Vertriebler in Personalunion. „Was manche als Schwäche sehen, ist für mich ein Vorteil: kurze Entscheidungswege, keine Overhead-Kosten, maximale Fokussierung“, argumentiert der Gründer.

Um sich gegen gut finanzierte Copycats abzusichern, braucht es allerdings einen technologischen Burggraben. Diesen sieht Opitek im Einsatz künstlicher Intelligenz. Er betont, man baue aktuell ein intelligentes Matching-System, das weit über eine klassische Suchmaske hinausgehe. „Nutzer sollen auf Basis ihrer individuellen Situation, ihrer beruflichen Ziele, dem Standort und den aktuellen Marktentwicklungen die passenden Weiterbildungen vorgeschlagen bekommen“, verspricht er. Nicht die erstbeste Option zähle, sondern die richtige. Opitek fasst den Kern seiner Technologie selbstbewusst zusammen: „Das ist keine Datenbank-Logik, das ist ein persönlicher Weiterbildungsberater, der rund um die Uhr verfügbar ist.“

Die Resterampe-Gefahr: Masse statt Klasse?

Die Marke von 150.000 Terminen ist zweifellos beeindruckend. Erreicht wurde dies, indem kursmap die Einstiegshürden für Anbieter bewusst bei null hält, sodass diese eigenständig Profile anlegen können. Genau hier liegt jedoch das größte Risiko: Marktplätze, die auf pure Quantität setzen, laufen schnell Gefahr, mit veralteten Daten oder unseriösen Angeboten der Coaching-Szene überflutet zu werden.

Wie verhindert das Start-up also, zur unregulierten Resterampe zu verkommen? Opitek wehrt sich vehement gegen den Verdacht mangelnder Kontrolle. „Ein niedriger Einstieg bedeutet nicht, dass wir die Augen verschließen, im Gegenteil“, kontert er. Laut dem Geschäftsführer werden alle Profile laufend überprüft, und es gebe klare Prozesse zum Eingreifen. Dass man auf aufwendige Onboarding-Gespräche oder intransparente Anforderungen verzichtet, sei eine sehr bewusste Entscheidung gewesen. Opitek rechtfertigt diesen Weg: „Das schadet besonders kleinen, oft hervorragenden Anbietern, die schlicht nicht die Kapazitäten für bürokratische Hürden haben.“ Sein Credo für die Plattform lautet daher: „Wer gute Kurse anbietet, soll sofort loslegen können. Qualität muss man sich nicht erzwingen, man muss sie fördern.“

Wer zahlt am Ende die Rechnung?

Das Geschäftsmodell basiert auf der kostenlosen Listung für Anbieter*innen, um zügig ein attraktives Angebot aufzubauen. Das Kalkül: Sobald darüber Leads generiert werden, lassen sich diese künftig über Premium-Modelle monetarisieren. Doch um überhaupt Lernende auf die Plattform zu locken, muss kursmap in Google Ads und im organischen Ranking hart gegen etablierte Portale kämpfen – ein Spiel, das meist massiv Kapital verbrennt.

Finanziert das Start-up diesen teuren Sichtbarkeitskampf aus eigener Kraft, oder braucht es dringend externes Venture Capital (VC)? Opitek setzt auf organisches Wachstum durch SEO. „Hochwertige, relevante Inhalte sind die nachhaltigste Investition, die eine Plattform wie kursmap machen kann“, erklärt er. Sichtbarkeit, die man sich hart erarbeite, sei langlebiger als erkaufte Reichweite. Er räumt zwar ein, ergänzend Google Ads zu nutzen, betont jedoch, dass dies hochgradig selektiv passiere. „Kursmap ist und bleibt bootstrapped“, stellt der Gründer klar. Das zwinge das Unternehmen zur Disziplin. Risikokapital sieht er derzeit eher pragmatisch: „Venture Capital ist für uns kein Ziel, sondern eine Option, die wir nur dann in Betracht ziehen würden, wenn sie uns schneller zu unserem Ziel bringt, nicht als Ersatz für ein funktionierendes Modell.“

Der B2B-Pivot: Raus aus dem Google-Hamsterrad

Kursmap agiert in einem Haifischbecken und tritt gegen Portale wie KURSNET, Semigator oder Tech-Riesen wie LinkedIn Learning an. Deutlich spannender als das margenschwache Vermittlungsgeschäft ist daher die langfristige Vision: Opitek plant B2B-Lösungen, mit denen Unternehmen ihre Weiterbildungsbudgets direkt über kursmap verwalten können. Gelingt dieser Wechsel zum B2B-SaaS-Modell, würde sich das Start-up aus der völligen Abhängigkeit vom Google-Traffic befreien.

Doch warum sollten Personalleiter*innen einem Neuling vertrauen statt auf bewährte Features ihrer HR-Software wie Personio oder Workday zu setzen? Auf die konkrete Frage nach der B2B-Strategie bleibt Opitek bei der technischen Ausführung vage und gibt offen zu: „Wie genau wir ihn gestalten, ob als eigenständiges HR-Tool oder als integriertes Feature für Unternehmen, wird die Marktentwicklung zeigen. Wir sind da ehrlich: Wir testen, lernen und passen uns an.“ Gleichzeitig grenzt er sich aber scharf von großen Suiten ab, die oft die inhaltliche Qualität von Weiterbildungsentscheidungen vernachlässigen würden. „Ein Unternehmen, das diesen Mehrwert für seine Mitarbeitenden spürt, wird kursmap nicht als Konkurrenz zu Personio oder Workday sehen, sondern als sinnvolle Ergänzung“, ist Opitek überzeugt.

Booking.com der Bildung oder teure Illusion?

Kursmap greift ein reales Problem in einem oft digital rückständigen Markt auf. Ob das Start-up langfristig aber das „Booking.com für Fortbildungen“ wird, hängt von rigoroser Qualitätssicherung, effizienter Traffic-Skalierung und der Umsetzung der B2B-Pläne ab.

Bleibt am Ende die Frage nach der Langzeitstrategie: Exit oder Industriestandard? Der Gründer strebt die Spitze im deutschsprachigen Raum an, indem man als „aktiver Partner“ fungiere. Gerade weil KI derzeit ganze Berufsbilder umkrempele, bräuchten Menschen laut Opitek keine bloßen Trefferlisten mehr.

„Kursmap soll genau diese Orientierung geben, datenbasiert, individuell, zukunftsgerichtet“, formuliert Opitek seine Ambition. Sollte dies in Deutschland greifen, schließt er eine Expansion nach Europa nicht aus. Einem unkontrollierten Hype erteilt er zum Schluss jedoch eine deutliche Absage: „Wir denken nicht in Szenarien, sondern in Meilensteinen. Erst liefern, dann skalieren.“

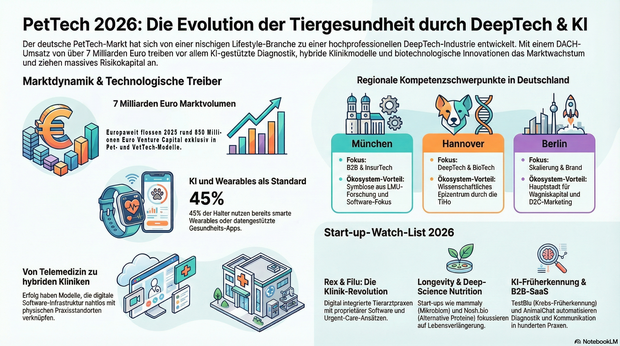

PetTech-Start-up-Report 2026

Wie DeepTech und KI den aktuellen PetTech-Markt prägen und welche Start-ups das Segment hierzulande dominieren. Plus: Die exklusive Start-up-Watch-List.

In den vernetzten De-Novo-Kliniken Berlins und Münchens scannen KI-Algorithmen heute in Millisekunden die MRT-Bilder von Haustieren, während personalisierte Longevity-Supplemente vollautomatisch an das Smart-Home der Halter geliefert werden. Der Vierbeiner des Jahres 2026 ist ein Premium-Patient und voll integrierter digitaler Lifestyle-Avatar, der eine hochkomplexe Gesundheitsökonomie antreibt. Venture-Capital-Fonds analysieren mittlerweile die Auslastungsquoten tierärztlicher Computertomographen genauso akribisch wie die wiederkehrenden Software-Umsätze im B2B-Sektor.

Wir blicken auf eine knallhart professionalisierte Industrie, in der radikale Effizienz und DeepTech den Takt angeben. Es geht um Algorithmen-gestützte Frühdiagnostik, hochskalierbare Praxis-Infrastrukturen und biotechnologische Nahrung – eine Ära, in der pure Tierliebe direkt auf tiefgreifende wissenschaftliche Innovation trifft und Investitionen in Milliardenhöhe rechtfertigt.

Ein hochreifer Milliardenmarkt unter KI-Einfluss

Der deutsche Markt für Heimtiere hat einen beispiellosen Reifegrad erreicht. Mit weit über 34 Millionen Haustieren allein in der Bundesrepublik sprechen wir von einem adressierbaren Markt, der längst nicht mehr nur Premium-Futter, sondern zunehmend hochpreisige Gesundheits- und Tech-Dienstleistungen konsumiert. Der technologische Haupttreiber im Jahr 2026 ist zweifelsohne die künstliche Intelligenz, dicht gefolgt von tiefen Integrationen des Internets der Dinge im Alltag der Tiere.

Laut einer aktuellen Bitkom-Studie nutzen mittlerweile über 45 Prozent der Halter*innen in Deutschland smarte Wearables oder datengestützte Gesundheits-Apps für ihre Tiere. Das spiegelt sich auch in den Bilanzen wider: Der Branchenumsatz im DACH-Raum hat die 7-Milliarden-Euro-Marke signifikant überschritten. Dabei flossen laut jüngsten Auswertungen von KfW Research im vergangenen Jahr europaweit rund 850 Millionen Euro Venture Capital exklusiv in Pet- und VetTech-Modelle.

Die neuen Treiber: Kliniken, Longevity und SaaS-Infrastruktur

Aktuell dominieren im PetTech-Sektor drei hochspezifische Sub-Sektoren den Markt. Allen voran steht der Bereich der De-Novo Vet-Tech-Kliniken. Hier verschmelzen physische Tierarztpraxen mit einer proprietären, durchdigitalisierten Software-Infrastruktur, die von der Terminbuchung bis zur KI-gestützten Diagnostik reicht. Etablierte Pioniere wie das Berliner Start-up Rex haben den Weg für diese hybriden Modelle geebnet.

Ein weiterer massiver Treiber ist die Pet-Longevity in Kombination mit DeepTech-Nutrition. Hier geht es nicht mehr um getreidefreies Futter, sondern um mikrobiom-basierte Nahrungsergänzungen und Alternative Proteine aus dem Bioreaktor, die das Leben der Tiere nachweislich verlängern sollen.

Der dritte dominierende Sektor ist B2B-Vet-SaaS. Start-ups bauen spezialisierte Software für Tierärzte, die Bilderkennung für Scans automatisiert und dem chronischen Fachkräftemangel in den Praxen entgegenwirkt.

Die geplatzten Träume der Solo-Telemedizin

Doch der Weg in dieses reife Marktumfeld war gepflastert mit schmerzhaften Lektionen. Der prominenteste Crash der jüngeren Vergangenheit war die spektakuläre Insolvenzwelle im Bereich der reinen Pet-InsurTechs und Solo-Telemedizin-Plattformen um das Jahr 2023 und 2024. Ein Paradebeispiel war das Berliner Neo-Versicherungs-Start-up Coya, das sich stark auf Tierversicherungen fokussiert hatte, vom französischen Konkurrenten Luko geschluckt wurde und letztlich in einem Insolvenzverfahren endete. Gleichzeitig verbrannten reine Tele-Vet-Apps, die ohne eigene physische Kliniken operierten, Millionen an VC-Geldern.

Aus diesen Debakeln lassen sich vier konkrete, fatale Fallstricke für heutige Gründer ableiten. Erstens die tödliche B2C-Kund*innenakquisitions-Falle: Wer heute im Pet-Bereich rein auf Performance-Marketing in sozialen Netzwerken setzt, wird von den astronomischen Customer Acquisition Costs erdrückt. Zweitens die Ignoranz gegenüber der Regulatorik, insbesondere der Gebührenordnung für Tierärzte. Der Gebührenschock der vergangenen Jahre brach Geschäftsmodellen das Genick, die diese Preissteigerungen nicht einkalkuliert hatten. Drittens das Dogma, dass Technologie den persönlichen Kontakt ersetzen kann: Haustiere können nicht ausschließlich über einen Bildschirm behandelt werden; wer keine physischen Anlaufstellen hat, scheitert an der Realität der Tiermedizin. Viertens die Vernachlässigung der Unit Economics zugunsten eines ungesunden Wachstums, was in einem Markt mit starker lokaler Bindung unweigerlich zum Cashflow-Kollaps führt.

Das deutsche PetTech-Netzwerk

Die deutsche PetTech-Landschaft hat sich auf wenige, aber extrem leistungsstarke Hubs konzentriert. München führt diese Liste unangefochten an. Mit der Ludwig-Maximilians-Universität, die eine der weltweit angesehensten tierärztlichen Fakultäten beheimatet, und dem InsurTech Hub Munich entsteht hier die perfekte Symbiose aus medizinischer Forschung und starkem B2B-Software-Fokus. Hannover verteidigt seinen Status als wissenschaftliches Epizentrum durch die Stiftung Tierärztliche Hochschule Hannover. Aus dem Umfeld dieser Elite-Forschungseinrichtung entspringen derzeit die tiefgreifendsten DeepTech- und BioTech-Ausgründungen der Branche. Berlin hingegen bleibt die unangefochtene Hauptstadt für Skalierung, Wagniskapital und D2C-Brandbuilding. Hier sitzen die großen Geldgeber*innen und Marketing-Genies, gestützt durch lokale Netzwerke. Leipzig komplettiert das Quartett als aufstrebender Star: Die Kombination aus der Veterinärmedizinischen Fakultät der Universität Leipzig und der BioCity, einem exzellenten Cluster für Biotechnologie, zieht zunehmend Start-ups an, die an der Schnittstelle von Tiergesundheit und Zellbiologie arbeiten.

Investor*innen-Radar

Das Kapital fließt heute intelligenter und zielgerichteter. Bei den spezialisierten VCs dominieren Fonds wie Five Seasons Ventures, die tiefes Verständnis für die Schnittstelle von FoodTech und Pet-Nutrition mitbringen, sowie global agierende Vehikel wie der Companion Fund. Im Bereich der Top-Tier Generalisten haben europäische Schwergewichte wie Cherry Ventures, Vorwerk Ventures und DN Capital den Sektor für sich entdeckt und pumpen beträchtliche Summen in hybride Klinik-Modelle und B2B-SaaS. Ein wesentlicher Machtfaktor sind mittlerweile die Corporate VCs der Industrie. Fressnapf dominiert mit seiner Beteiligungsgesellschaft die Früh- und Wachstumsphase strategisch, während Mars Petcare über seinen Arm Kinship massiv nach Europa drängt.

Der eigentliche Motor der Innovation liegt jedoch bei den Frühphasen-Motoren und Business Angels. Hier brillieren Köpfe wie Lukas Keindl, der als Gründer des US-Vorbilds Bond Vet nun aktiv sein Know-how und Kapital in die europäische Gründerszene pumpt, sowie spezialisierte Angel-Syndikate und Netzwerke wie der Auxxo Female Catalyst Fund, die gezielt diverse Gründungsteams in der Tiermedizin fördern.

Die Top-PetTech-Start-ups (Must-Watch)

Die nachfolgende Auswahl der Top Start-ups basiert auf einer strengen redaktionellen Analyse. Die zentralen Kriterien für die Aufnahme in dieses Ranking sind eine nachgewiesene Marktrelevanz durch messbares Praxis- oder Nutzerwachstum, ein hoher technologischer Reifegrad fernab reiner Konzeptphasen sowie das ausdrückliche Vertrauen namhafter Lead-Investoren. Um die aktuelle Innovationskraft des deutschen Ökosystems abzubilden, haben wir uns ausschließlich auf deutsche Start-ups konzentriert, deren Gründung im Jahr 2020 oder später erfolgte. Die Liste beleuchtet bewusst eine Diversität an Geschäftsmodellen, von B2B-Software über BioTech bis hin zu hybriden Versorgungskonzepten.

Rex

Das im Jahr 2021 von Julian Lechner und Jonathan Loesing gegründete Berliner Start-up Rex ist das aktuelle Paradebeispiel für moderne Tiermedizin. Rex kombiniert ein B2B/B2C-Hybrid-Modell und baut architektonisch anspruchsvolle, digital voll integrierte T Tierärzt*innenpraxen auf. Der USP liegt in der proprietären Praxismanagement-Software, die den Tierärzt*innen die Administration abnimmt, und der nahtlosen App-Experience für den Tierhalter. Das enorme Potenzial dieses Modells überzeugte Vorwerk Ventures, Picus Capital und weitere namhafte Investor*innen, die dem Unternehmen bereits zweistellige Millionenbeträge anvertrauten.

Filu

Ebenfalls angetreten, um den chronisch überlasteten Tierärzt*innenmarkt zu revolutionieren, ist das Münchner Start-up Filu. Gegründet 2022 von Anna Magdalena Naderer, Christian Köhler und Justus Buchen, positioniert sich das Unternehmen mit seinem Urgent-Care-Ansatz gekonnt zwischen klassischer Allgemeinpraxis und Notfallklinik. Die Kombination aus modernster Hardware vor Ort und smarten Tele-Triage-Prozessen im Hintergrund sorgt für eine extrem hohe Effizienz. Lead-Investoren wie DN Capital und YZR Capital haben das immense Skalierungspotenzial früh erkannt und die Expansionspläne befeuert.

mammaly

Im Bereich der D2C-Tiergesundheit setzt das 2020 in Köln von Stanislav Nazarenus und Alexander Thelen gegründete Start-up mammaly neue Standards. Das Geschäftsmodell basiert auf dem Direktvertrieb von hochwirksamen, mit Tierärzt*innen entwickelten Nahrungsergänzungsmitteln in Snackform. Der USP liegt in der tiefgreifenden Fokussierung auf das Mikrobiom von Hunden, um altersbedingte Beschwerden proaktiv zu lindern. Dieses datengetriebene und markenstarke Konzept sicherte mammaly unter anderem ein substanzielles Funding durch den spezialisierten VC Five Seasons Ventures.

PetLEO

Dieses 2020 in München von Karim Abdo und Bülent Hacioglu gegründete Unternehmen agiert als eine hochkomplexe B2B2C-Gesundheitsplattform. PetLEO verbindet Tierärzt*innen, Expert*innen und Haustierbesitzer*innen in einem geschlossenen, digitalen Ökosystem. Tierhalter*innen können Gesundheitsdaten verwalten, Giftköder-Warnungen erhalten und Termine buchen, während die Praxen selbst eine moderne Schnittstelle zur Kund*innenbindung erhalten. Das Start-up hat sich durch starke Partnerschaften mit Industrie und Versicherungen eine äußerst wehrhafte Marktposition als digitaler Alltagsbegleiter erarbeitet.

Hundeo

Dass man auch ohne massive externe Kapitalrunden im PetTech-Markt dominieren kann, beweist das 2020 von Enrico Bachmann in Berlin gegründete Start-up Hundeo. Das B2C-EdTech-Modell ist eine gamifizierte App für modernes Hundetraining. Der technologische USP ist die personalisierte, KI-gestützte Trainingsplanung, die sich dem Lernfortschritt des jeweiligen Tieres anpasst. Mit enormem organischem Wachstum und starker Nutzer*innenbindung gehört das gebootstrappte Hundeo zu den profitablen Vorzeige-Start-ups der App-Economy.

Nosh.bio

Obwohl nicht exklusiv für den Pet-Markt gegründet, rüttelt das 2022 von Tim Fronzek und Felipe Lino in Berlin ins Leben gerufene DeepTech-Start-up Nosh.bio die Tiernahrungsindustrie fundamental auf. Das B2B-Geschäftsmodell fokussiert sich auf die Herstellung von Alternativen Proteinen aus Pilzmyzel. Der technologische USP liegt in einem hocheffizienten Fermentationsprozess, der saubere, hochverdauliche und texturstarke Proteinquellen aus Pilzmyzel liefert. Als hochfunktionale „Clean-Label“-Zutat ermöglicht sie die Entwicklung erstklassiger, fleischfreier Tiernahrung – völlig ohne chemische Zusätze und ohne den massiven ökologischen Fußabdruck der konventionellen Fleischindustrie. Lead-Investor Earlybird unterstützt dieses zukunftsweisende BioTech-Modell.

TestBlu

Mit Gründung im Jahr 2022 in Potsdam bringt TestBlu echte Deep-Science in die tierärztliche Praxis. Das von Shahab Shoaei Matin geführte Geschäftsmodell ist ein KI-gestütztes B2B-SaaS-Produkt für Veterinärkliniken. Der USP des Unternehmens ist Deutschlands erster Bluttest zur Früherkennung von Krebs bei Hunden. Ein hochkomplexer Algorithmus analysiert Blutbilder auf Anomalien mit enormer Präzision. TestBlu positioniert sich als unverzichtbarer onkologischer Co-Pilot für Tierärzt*innen, um die diagnostische Sicherheit drastisch zu erhöhen.

AnimalChat

Die 2020 von Sebastian Wilkes und dem erfahrenen Tierarzt Dr. Heinrich Wilkes aus Borken gestartete B2B-Software AnimalChat hat das Problem der ineffizienten Kommunikation in Praxen radikal gelöst. Das Start-up bietet einen DSGVO-konformen, professionellen Messenger-Dienst speziell für Veterinär*innen und deren Klient*innen an. Der USP ist die nahtlose Integration von asynchroner Kommunikation und digitaler Wundverlaufskontrolle, ohne dass der Arzt bzw. die Tierärztin seine bestehende Praxissoftware austauschen muss. Dieses pragmatische, aber hochskalierbare Tool hat sich in hunderten Praxen als Standard etabliert.

Internationaler Ausblick & Fazit

Wer heute verstehen will, was morgen in Europa passiert, muss den Blick zwingend über den Tellerrand richten. Drei globale Makro-Trends werden den deutschen PetTech-Markt in Kürze massiv umwälzen. Aus den USA schwappt die Welle der Longevity-Pillen herüber, wo Start-ups bereits erste FDA-Zulassungen für Medikamente anstreben, die das biologische Altern von Hunden verlangsamen. Asien hingegen definiert den Standard für Hyper-Vernetzung neu: Hier sind smarte Katzentoiletten und vollautomatische, mit dem Smart-Home synchronisierte Futterautomaten, die Gesundheitsdaten in Echtzeit an den Tierarzt bzw. die -ärztin senden, bereits Massenmarkt. In Israel, dem weltweiten Hub für FoodTech, verschmilzt derweil AgriTech mit Tiernahrung. Kultiviertes Fleisch aus dem Labor für Premium-Tiernahrung steht dort nach der ersten regulatorischen Marktzulassung für Heimtierfutter in Großbritannien durch das Start-up Meatly endgültig vor dem globalen Durchbruch.

Das Fazit für 2026 ist eindeutig: Der Welpenschutz für Gründer*innen ist abgelaufen. PetTech ist ein knallhartes Business, das exzellente Unit Economics, tiefes regulatorisches Verständnis und echte technologische Alleinstellungsmerkmale verlangt. Investor*innen suchen heute nach Geschäftsmodellen, die reale Engpässe wie den Tierärzt*innenmangel lösen oder die Lebensspanne der Tiere durch harte Wissenschaft verlängern. Wer in diesem 20-Milliarden-Markt mitspielen will, muss beweisen, dass er/sie nicht nur Tiere liebt, sondern vor allem sein/ihr strategisches und technologisches Handwerk versteht.