Aktuelle Events

Die Testbirds im App-Flug

Software-Crowdtesting

Das junge Start-up Testbirds bietet Software-Tests für neue Apps und Webanwendungen. Das Besondere daran: Mit Hilfe echter Internet-Nutzer, die die Software unvoreingenommen prüfen, werden vor dem Markteintritt Fehler gefunden und damit die Produkte verbessert.

Die Idee der App ist sehr cool." "Das drehen der Symbole ist super gemacht!" "Sehr große Auswahl an verschiedenen Designs und Gestaltungsmöglichkeiten." Derartiges Lob ist gern gesehenes Feedback für den Herausgeber einer App. Was aber, wenn die Bewertungen im Store weniger positiv oder gar vernichtend ausfallen? "Die App hat sehr viele Bugs! Ich habe mein Vertrauen in diese App so gut wie komplett verloren." Im hart umkämpften App-Markt können solche Rezensionen den Todesstoß bedeuten. Das junge Münchner Start-up Testbirds bietet Entwicklern seit Ende 2011 die Möglichkeit, ihr Produkt bereits vor dem Release von echten Nutzern testen zu lassen.

Crowdtesting via Internet

"In der Realität verhalten sich die Menschen oft ganz anders, als man es eigentlich erwarten würde", erklärt Philipp Benkler, der bei Testbirds für die Entwicklung der Plattform zuständig ist. "Das trifft natürlich auch auf die Nutzung von Software zu." Zusammen mit Georg Hansbauer und Markus Steinhauser bietet er einen Service, der für viele Unternehmen und Entwickler noch ein Fremdwort ist: Crowdtesting. "Herkömmliche Testing-Methoden von Software können den Bedarf einfach nicht mehr decken", weiß auch Georg Hansbauer, der während seines Studiums selbst Erfahrung in der Qualitätssicherung großer Unternehmen gesammelt hat. "Durch die ständig steigende Anzahl unterschiedlicher Geräte, Betriebssysteme und Versionen wird es zudem immer schwieriger, Kompatibilität auf allen Systemen zu gewährleisten."

Testbirds hat den Ansatz des Crowdsourcing, also das Nutzen der Arbeitskraft der Masse über das Internet, auf das Testen von Software übertragen. "Im Prinzip kann sich jeder bei uns als Tester registrieren", erklärt Markus Steinhauser, der im Team für den Bereich Marketing und PR verantwortlich ist. "Mit dem Computer, Smartphone oder Tablet lässt sich so, ganz einfach von der Couch aus, etwas Geld hinzuverdienen." Die Tester suchen Bugs und geben Feedback zur Benutzerfreundlichkeit des Produkts. Anhand detaillierter Profile ist es möglich, die Meinung bestimmter Zielgruppen einzuholen, bevor die App auf den Markt kommt.

Und so funktioniert das Crowdtesting: Jedem Projekt wird ein eigener Projektmanager, der sogenannte Birdmaster, zugeordnet. Er koordiniert die Tester, kontrolliert die Berichte und arbeitet eng mit dem Kunden zusammen. "Wir versuchen, jedes Projekt so individuell wie nur möglich zu gestalten", so Philipp Benkler weiter. "Wer soll testen? Was soll getestet werden und vor allem, mit welchen Geräten? Diese Fragen gilt es vorab zu klären." Qualität spielt nach Ansicht des Teams dabei die entscheidende Rolle. Vor allem in Deutschland sei dieser Faktor, genau wie ein enger Kundenkontakt, extrem wichtig. Ein weiterer Vorteil ist die hohe Flexibilität der Tester. Nach dem Briefing mit dem Kunden kann ein Projekt bereits innerhalb weniger Stunden starten.

Die Kraft der Masse macht’s

Neben Apps kann somit alles getestet werden, was über das Internet zugänglich ist. "Das sind vor allem Onlineshops und ganz normale Webseiten", erklärt Georg Hansbauer. Die eigene Plattform zur Abwicklung der Tests hat das Team innerhalb weniger Wochen selbst entwickelt. Dort erstellen die Tester ihre Berichte, erfassen Bugs und geben auch Rückmeldung an die Testbirds. "Manchmal fehlt ein bestimmtes Smartphone zur Auswahl, oder die Tester haben Verbesserungsvorschläge. Dadurch profitieren auch wir durch die Kraft der Masse", erklärt Markus Steinhauser. Aber auch Kunden können sich im Nest, wie die Testbirds ihre Plattform nennen, einloggen. Dort lassen sich alle angenommenen Berichte und Bugs, inklusive Screenshots oder Screencasts, einsehen und herunterladen. "Der Bedarf ist auf jeden Fall vorhanden", ist sich Philipp Benkler sicher. "Unsere Kunden reichen bereits jetzt von Start-ups über Agenturen bis hin zu Großunternehmen."

Hilfe von friends and family

Während ihres gemeinsamen Studiums des Finanz- und Informationsmanagements in München und Augsburg hatten Philipp und Georg bereits die Gelegenheit, Erfahrungen im Bereich der Softwareentwicklung zu sammeln. Doch wer testet, wenn nicht genügend Zeit und Geld vorhanden ist, um es selbst zu machen? "Das waren zuerst mal Freunde und Verwandte", schmunzelt Philipp Benkler. "Aber auch Großunternehmen haben oft dasselbe Problem. Der Entwickler kennt seine Software auswendig. Und Praktikanten können nicht alles alleine testen."

Testbirds sieht Software-Testing durch die Crowd daher als ideale Ergänzung zum internen Testen. Unveröffentlichte Apps werden über die Plattform direkt an die Tester verteilt. "Ein neues Spiel vorab ausprobieren zu können, das schafft natürlich auch für die Tester einen besonderen Anreiz", so Markus Steinhauser. Nach seinem Studium der Medien- und Kommunikationswissenschaft in der Schweiz arbeitete er für einige Zeit als Journalist, bevor sein Schulfreund Philipp mit der Idee auf ihn zukam. "Seitdem kann ich meine persönliche Begeisterung für neue Medien und soziale Netzwerke bei Testbirds ausleben."

Startfinanzierung aus eigener Hand

Um sich neben der obligatorischen Recherche einen eigenen Eindruck über den Markt in Deutschland zu verschaffen, befragten die Gründer knapp 300 Entscheider aus dem Bereich Softwareentwicklung zum Thema Testing. Die nötigen Kontakte lieferte das Business-Netzwerk Xing. "Spätestens zu diesem Zeitpunkt war uns klar, dass die aktuelle Situation auch aus Sicht der Entwickler keinesfalls zufriedenstellend ist", blickt Georg Steinhauser zurück. Aus den Ergebnissen wurde eine Info-Broschüre zum Stand des Testings in Deutschland erstellt. "Außerdem hatten wir dadurch bereits eine große Anzahl an potenziellen Kunden, die natürlich alle ein Exemplar bekommen haben", schildert Georg Steinhauser die erste Vertriebsmaßnahme des Unternehmens. Rasch wuchs das Team auf knapp zehn Personen an. Ein Projektteam arbeitete an neuen Vertriebskonzepten, weitere Studenten kümmerten sich um die telefonische Kundenakquise und das Marketing. "Da wir bereits nach kurzer Zeit Umsatz machen konnten, hat das gut funktioniert", erklärt Philipp Benkler.

Auszeichnung, Finanzierung, Wachstum

Beim Münchener Businessplan Wettbewerb im Jahr 2012 wurde Testbirds für sein Geschäftsmodell mit dem dritten Platz ausgezeichnet und war Preisträger des Gründerwettbewerb ITK Innovativ. "Vor allem hier in Bayern hat uns die Teilnahme am Gründerwettbewerb hohe Aufmerksamkeit beschert", freut sich Markus Steinhauser. "Erst kürzlich wurden wir durch unseren damaligen Sieg wieder zu einer Gründerveranstaltung als Redner eingeladen". Im Oktober dieses Jahres gewann das Team außerdem den Best of Mobile Award in der Kategorie Special B2B und setzte sich dabei unter anderem gegen Firmen wie die Deutsche Post durch, deren App DocWallet von Testbirds getestet wurde.

Noch im im Jahr 2013 konnten die Gründer einen privaten Investor für sich gewinnen. Die Walter Beteiligungen und Immobilien AG investierte einen siebenstelligen Betrag in das Unternehmen, hauptsächlich, um das Team auszubauen und schnelleren Wachstum zu ermöglichen. Angestoßen durch diese Finanzierung beschäftigt Testbirds mittlerweile mehr als 25 Mitarbeiter und arbeitet aktuell an der Internationalisierung mit Zweigstellen in Großbritannien und den Niederlanden. "Beide Märkte bieten innerhalb Europas besonders großes Potenzial für Crowdtesting", meint Philipp Benkler, der mittlerweile für die Internationalisierung zuständig ist. "Unter anderem waren geringe Sprachbarrieren sowie die jeweils überdurchschnittlich hohe Smartphone-Penetration ausschlaggebend", so seine Begründung.

Außerdem ist seit September dieses Jahres ein Franchise-Unternehmen in Ungarn am Markt, welches dort Crowdtesting unter der Marke Testbirds anbietet. "Um ehrlich zu sein war dieser Schritt nicht wirklich geplant", verrät Georg Hansbauer. "Wir haben die Kollegen aus Budapest bei der Communication World kennengelernt. Sie waren so begeistert von unserem Konzept, dass schon ein halbes Jahr später der Franchise-Vertrag unter Dach und Fach war."

Crowdtesting mit enormem Potenzial

Mittlerweile zählen Unternehmen wie die Deutsche Post, Allianz SE oder Audi zu den Kunden von Testbirds. "Crowdtesting hat sich in den letzten beiden Jahres zu einem festen Begriff in der Branche entwickelt", sagt Markus Steinhauser, der sich weiterhin um die Öffentlichkeitsarbeit bei Testbirds kümmert. Trotzdem bestehe immer noch viel Bedarf an Aufklärung über die Möglichkeiten dieses Konzepts. "Wir arbeiten daran!", so Steinhauser. Inhaltlich hat sich das Portfolio des Start-ups weiterentwickelt, nicht nur durch den Relaunch der eigenen Plattform Ende letzten Jahres. "Der Markt entwickelt sich vor allem im mobilen Bereich sehr schnell, als junges Unternehmen können wir uns zum Glück sehr viel Flexibilität erlauben", meint Benkler.

Zum Beispiel haben Kunden nun die Möglichkeit, einen Self-Service nutzen um kleinere Testläufe kurzfristig selbst zu starten. Vor allem im Usability-Bereich betreut Testbirds die Tests weiterhin selbst und wertet die Ergebnisse am Ende, inklusive Handlungsempfehlungen, aus. "Jeder Kunde hat unterschiedliche Anforderungen an unseren Service, um diesen in die eigene Entwicklung zu integrieren", so Hansbauer. Daher habe sich das Portfolio mittlerweile deutlich erweitert.

Testpartner der STARTplaner-App

Auch StartingUp profitierte vom Experten-Know-how von Testbirds. Im Herbst 2013 hat StartingUp seinen kostenlosen STARTplaner veröffentlicht - die App, die Gründer Schritt für Schritt auf dem Weg zur erfolgreichen Selbständigkeit begleitet. Die überaus positiven Download-Zahlen zeigen eindrucksvoll, dass dieses Planungs-Tool für Gründer sehr gut ankommt. Dies bestätigen auch die Testbirds, die den STARTplaner mit Hilfe einer jungen, gründungsaffinen Zielgruppe auf Herz und Nieren geprüft haben.

"Wir hätten uns zum Start selbst so eine App gewünscht", meint Markus Steinhauser. "Daher war es schön, dass wir unseren Teil zur Optimierung beitragen konnten." Teil des Tests war sowohl das Sammeln von Feedback der Nutzer als auch die Suche nach technischen Problemen auf unterschiedlichen Geräten.

Mehr zum Test und zu den Ergebnisse lesen Sie hier.

Und wohin fliegen die Testbirds?

Die Herausforderungen liegen für Testbirds momentan vor allem in der Internationalisierung. Für die Erweiterung und Betreuung der Tester-Crowd ist seit Anfang des Jahres ein dedizierter Community Manager eingestellt worden. Monatlich kommen nach eigenen Angaben mehrere tausend Tester aus unterschiedlichen Ländern hinzu. "Auch das Recruiting unserer internen Mitarbeiter ist deutlich internationaler geworden", sagt Steinhauser. Der Aufbau des Teams sei sicherlich eine der größten Herausforderungen im Moment, sind sich die Gründer einig. "Man muss einfach akzeptieren, dass die eigene Produktivität irgendwann abnimmt", erklärt Benkler. "Dafür werden wir als Team aber immer besser". Für das kommende Jahr steht damit einhergehend vor allem das Vorantreiben der Internationalisierung auf der Agenda.

"Inhaltlich wird es ebenfalls spannend", freut sich Hansbauer. "Im Consumer-Bereich dringen Apps in sämtliche Bereiche unseres Alltags vor. Außerdem erkennen Unternehmen zunehmend die Möglichkeiten interner Applikationen, zum Beispiel für die eigenen Mitarbeiter." Ab Januar zieht es die Testbirds dann in ein neues Nest. Die neuen Büros in der Nähe der Münchner Theresienwiese sollen genug Platz bieten, um auch 2014 weiter wachsen zu können.

Diese Artikel könnten Sie auch interessieren:

Fahrfuchs: Kein Führerschein, aber das Auto neu gedacht

Die Gründer Florian Ritzel und Jannik Kirchhoff aus Hamburg wollen das Problem der versteckten Autokosten lösen. Ihre App Fahrfuchs kletterte ohne Marketingbudget in die Top 100 der Finanz-Charts im App Store – eine klassische Bootstrapping-Erfolgsgeschichte. Doch wie tragfähig ist das Geschäftsmodell, wenn etablierte Konkurrenten den Markt beherrschen?

Während andere Abiturient*innen für Klausuren büffeln, programmierten Florian Ritzel und sein Mitgründer Jannik Kirchhoff (beide 18) ein Start-up. Die Initialzündung war laut den beiden Hamburger Gymnasiasten eine gesellschaftliche Beobachtung: Die Belastung durch Mobilitätskosten. „Die alleinerziehende Mutter sollte nicht an der Zapfsäule stehen müssen und entscheiden, ob sie ihr Kind in die Kita oder sich selbst zur Arbeit fährt“, beschreibt Ritzel die Motivation hinter dem Projekt. Die amüsante Ironie ihrer Gründung: Die Fahrfuchs-Gründer besitzen aktuell nicht einmal einen Führerschein.

Auf die naheliegende Skepsis bezüglich dieses fehlenden „Nutzer-Wissens“ reagiert Florian Ritzel offensiv: „Natürlich gibt es immer Leute, die unsere Idee kritisieren. Und fehlendes Nutzerwissen ist gerade am Anfang schwierig, vor allem, wenn man eine App bauen möchte, die möglichst vielen Menschen hilft.“ Doch aus der vermeintlichen Schwäche machten sie eine Stärke durch maximale Nutzerorientierung. „Wir haben bereits vorher im Umfeld rumgefragt, was die Leute eigentlich brauchen, und danach gezielt um Feedback gebeten“, erklärt der Gründer. Der Erfolg gibt ihnen recht: „Inzwischen erreichen uns täglich dutzende Mails mit Tipps – was die Nutzer*innen sich wünschen und wie wir die App verbessern können. Dadurch wird uns das Ganze nicht zum Verhängnis, sondern sogar zum Vorteil.“

Mit Fahrfuchs wollen sie den rund 48,5 Millionen Pkw-Halter*innen in Deutschland auf den Cent genau aufzeigen, wo das Auto wirklich Geld frisst. Denn der teure Kraftstoff ist nur ein Teil der Wahrheit. Falsche Versicherungstarife, unbemerkter Wertverlust, Wartung und vergessene Pendlerpauschalen reißen oft weitaus größere Löcher ins Budget. Die Resonanz ist für die frühe Phase beachtlich: Ganz ohne bezahltes Marketing sammelte die App schnell über 700 Downloads ein – eine für den Massenmarkt zwar noch bescheidene Zahl, die jedoch ausreichte, um mehrfach in die Top 100 der Finanz-Charts im App Store zu stürmen. Zudem generierte das Projekt rein organisch Presseberichte, unter anderem in der FAZ, der SWP und bei Antenne Bayern.

Holistischer Ansatz statt reiner Tank-App

Auf den ersten Blick wirkt Fahrfuchs wie ein weiterer Spritpreis-Radar. Die App zieht in Echtzeit Daten der Markttransparenzstelle für Kraftstoffe, listet Ladesäulen für E-Autos und alarmiert per Push-Nachricht bei günstigen Preisen. Der entscheidende Pivot ist jedoch das ganzheitliche Kostentracking: Die Gründer haben einen eigenen Versicherungsrechner sowie einen Steuer-Sparrechner integriert, bieten detaillierte Monatsreports an und binden die Nutzer*innen über einen Gamification-Ansatz („Sparfuchs-Score“). Ein zentrales Versprechen in Zeiten von Datenskandalen: Alle sensiblen Nutzer*innendaten werden lokal auf dem Endgerät gespeichert – es gibt keine zentrale Cloud.

Angesprochen auf die Skalierbarkeit dieses Modells bezieht Jannik Kirchhoff klar Stellung: „Die lokale Datenspeicherung ist gerade in Deutschland kein strategisches Eigentor. Ich halte nichts für wichtiger, als die privaten Daten unserer Nutzer*innen zu schützen“. Er warnt vor den Risiken zentraler Speicherlösungen: „Niemand muss wissen, wo ich wohne, wohin ich morgens fahre oder wo meine Kinder zur Kita gehen. Wir haben in der Vergangenheit immer wieder gesehen, dass jeder gehackt werden kann. Und gerade als junge Entwickler können und wollen wir diese Verantwortung nicht übernehmen“. Personalisierte Spar-Vorschläge ließen sich laut Kirchhoff auch direkt auf dem Smartphone „hervorragend realisieren“.

Ein echtes Haifischbecken

Die Vision ist ambitioniert, doch der Markt ist hart umkämpft. Die Konkurrenz reicht von Excel-Tabellen bis zu Platzhirschen wie Spritmonitor oder Giganten wie Clever Tanken. Warum also wechseln? Florian Ritzel gibt sich selbstbewusst: „Die Spritpreis-Übersicht ist bei uns nur eines von vielen Features – nicht der Hauptteil. Wer Spritmonitor so gut findet, darf dort gerne bleiben.“ Der Fokus liege woanders: „Wer aber wirklich tracken möchte, was sein Auto insgesamt kostet, der kann das eben nur bei uns. Diese Gesamtheit an Features gibt es bisher in keiner anderen App in dieser Form.“ Selbst das Argument der manuellen Excel-Tabelle lässt er nicht gelten: „Natürlich kann man sich das selbst in Excel bauen – aber darauf haben die meisten Leute schlicht keine Lust. Genau deswegen sind wir so gut.“

Kritisch hinterfragt

Trotz des Aufklärungscharakters ist Fahrfuchs kein reines Hobbyprojekt; In-App-Käufe für eine „Plus“-Version (0,99 €/Monat) sowie eine „Pro“-Version (2,99 €/Monat bzw. 19,99 €/Jahr) bilden das Monetarisierungsmodell. Ob die selbstgestrickte Mathematik hinter dem Versicherungsrechner, der auf hunderten per Hand durchgerechneten Profilen basiert, ohne echte API-Schnittstellen dauerhaft standhält, bleibt abzuwarten.

Wie viele Abonnent*innen braucht es, um nach dem Abitur davon zu leben? Jannik Kirchhoff rechnet vor: „Ehrlicherweise vermutlich mehr als 10.000 zahlende Abonnent*innen – aber das ist zunächst auch nicht unser Ziel.“ Aktuell stehe das Lernen im Vordergrund: „Wir wollen vor allem Erfahrungen sammeln durch das, was wir machen, und gleichzeitig die laufenden Kosten decken. Das sollte demnächst möglich sein.“

Für die Zeit nach dem Abschluss hält er sich alle Türen offen: „Risikokapital halte ich ab dem Moment für unumgänglich, an dem wir wirklich konkret expandieren wollen. Das wird vermutlich nach dem Abitur der Fall sein. Dann muss man schauen, ob es sich lohnt, Anteile abzugeben oder Kredite aufzunehmen.“ Sein Fazit: „Spannend wird es erst, wenn wir die Idee wirklich groß skalieren wollen.“

Ein exzellentes MVP mit Pivot-Potenzial

Fahrfuchs ist ein Lehrbuchbeispiel für ein hervorragendes Minimum Viable Product (MVP). Um jedoch hochprofitabel zu werden, könnte mittelfristig ein Wechsel hin zur Affiliate-Provision für Versicherungswechsel nötig sein. Doch hier bremst Florian Ritzel bewusst: „Versicherungspartner wollen wir zunächst bewusst nicht werden, denn einer der entscheidendsten Punkte unserer App ist, dass wir Versicherungsdaten unabhängig zur Verfügung stellen.“

Sein Ziel ist technologische Exzellenz: „Meilenstein eins ist, den Versicherungsrechner so akkurat zu machen, dass wir auf Check24-Niveau sind – ohne dafür Provisionen zu kassieren.“ Zudem plane man Kooperationen mit Fahrschulen und Werkstätten, um die Leute genau dort zu erreichen, „wo sie am meisten ans Auto denken“. Die größte Hürde bleibt derweil technischer Natur: „Meilenstein drei ist die Android-Version – das ist allerdings extrem schwer umzusetzen, gerade wenn man iOS-Coding gewohnt ist.“ Dennoch verspricht er: „Wir planen das aber innerhalb der nächsten drei Monate.“

Der Grundstein ist gelegt. Nun müssen die beiden Hamburger beweisen, dass sie nach dem Abitur nicht nur programmieren, sondern auch unternehmerisch durch den dichten Verkehr des Mobilitätsmarktes navigieren können.

KI gegen Beamtendeutsch: Wie ein Solo-Gründer den Markt für Nebenkosten aufrollt.

Für die meisten der rund 19 Millionen Mieterhaushalte in Deutschland ist sie ein jährliches Ärgernis: die Nebenkostenabrechnung. Laut dem Deutschen Mieterbund enthält jede zweite Abrechnung Fehler. Das fränkische Start-up NebenkostenPro will diesen intransparenten Markt nun mithilfe Künstlicher Intelligenz radikal vereinfachen – und zwar für beide Seiten.

Bisherige Lösungsansätze für fehlerhafte Abrechnungen – von unzulässigen Verwaltungskosten bis zu falsch umgelegten Reparaturen – waren für Mieterinnen und Mieter oft teuer oder zeitaufwendig. Der Gang zur Anwaltskanzlei frisst die Ersparnis schnell auf, Mietervereine binden einen an jährliche Mitgliedschaften und etablierte LegalTech-Wettbewerber verlangen für eine manuelle Prüfung meist rund 50 Euro.

Hinter dem Lösungsansatz von NebenkostenPro steht kein großes Entwicklerteam, sondern Julian Falk, ein Solo-Gründer aus Zirndorf bei Nürnberg. Auf die Frage, wie man sich freiwillig in die juristischen Untiefen der Betriebskostenverordnung stürzt, hat Falk eine verblüffend einfache Antwort: „Ehrlich gesagt war der Auslöser ziemlich banal“, erinnert sich der Gründer. „Ich habe selbst als Mieter eine Nebenkostenabrechnung bekommen, bei der die Zahlen einfach nicht plausibel wirkten“.

Als er sich einlesen wollte, landete er prompt im deutschen Paragraphendschungel. „Da habe ich gemerkt: Wenn ich als technikaffiner Mensch schon Probleme habe, das zu durchdringen, wie soll das ein normaler Mieter schaffen?“ Falk erkannte schnell, dass die Betriebskostenverordnung im Kern aus klaren Wenn-Dann-Strukturen besteht. „Das schreit förmlich nach Automatisierung“, fasst er seinen Heureka-Moment zusammen.

KI als Herausforderer im zweiseitigen Markt

Was als Wochenendprojekt begann, wuchs schnell. Heute nutzt die Plattform eine komplexe Pipeline aus mehreren KI-Modellen, um hochgeladene PDF-Dokumente und Fotos auszulesen, zu strukturieren und juristisch einzuordnen. Der Clou dabei ist der duale Ansatz, der beide Marktseiten bedient. Für Mieter*innen dient das Tool zunächst der Symptombekämpfung, indem ein initialer Schnellcheck die hochgeladenen Daten kostenlos mit lokalen Vergleichswerten abgleicht. Der detaillierte Prüfbericht startet bei einer preislichen Kampfansage von 7,90 Euro. Für Vermieter*innen fungiert die Plattform hingegen als Software-as-a-Service zur rechtskonformen Erstellung der Abrechnungen.

Dieses B2B-Abo-Modell ist für das Überleben der Firma essenziell. Es sorgt für den dringend benötigten wiederkehrenden Umsatz, der das stark saisonale, von geringer Kund*innenbindung geprägte Mieter*ingeschäft wirtschaftlich ausbalanciert.

Wer nun glaubt, hinter einer solch komplexen KI-Pipeline stünden „Heerscharen“ von Investoren, irrt. „NebenkostenPro ist komplett eigenfinanziert. Es gibt keine externen Geldgeber, keine Investoren, keine Beteiligungen“, betont Falk. Das Modell trage sich mittlerweile selbst – für Falk ein Blick in die Zukunft der Softwareentwicklung. „KI verändert gerade fundamental, wie Software-Unternehmen entstehen. Die Werkzeuge, die heute verfügbar sind, machen einen einzelnen Gründer so produktiv wie früher ein ganzes Team.“ Die Rolle des/der Entwickler*in verschiebe sich zunehmend zum/zur Architekt*in, der lediglich die Richtung vorgebe und Ergebnisse validiere.

Smarte Daten als Reichweiten-Hebel

Um gegen etablierte LegalTech-Player wie Wenigermiete oder Mieterengel anzukommen, fehlte dem Solo-Gründer schlicht das Marketingbudget. Falks clevere Antwort: Er baute eine frei zugängliche Wissensdatenbank mit kommunalen Nebenkostendaten für rund 400 deutsche Städte auf – von Grundsteuer-Hebesätzen bis zu lokalen Wasserpreisen.

Ein massiver Hebel, der sich auszahlt: Die Datenbank wird mittlerweile sogar von Google und KI-Modellen wie ChatGPT als primäre Quelle zitiert, was organischen Traffic generiert, ohne teure Klickpreise für umkämpfte Keywords zahlen zu müssen.

Konvertiert dieser Traffic auch? „Die Seite rankt für zahlreiche organische Keywords, der Traffic vervielfacht sich von Monat zu Monat“, freut sich der Gründer. Das beste Marketing sei ohnehin die Mundpropaganda erfolgreicher Nutzer*innen. Eine Entwicklung verblüfft den Zirndorfer dabei besonders: „Was mich überrascht hat: Die Vermieterseite wächst schneller als die Mieterseite.“ „Viele private Kleinvermieter kämpfen sich jedes Jahr mit Excel durch ihre Abrechnung und sind dankbar, wenn ihnen das jemand abnimmt.“

Juristisches Minenfeld und das Haftungsrisiko

Doch wo KI auf deutsches Mietrecht trifft, lauern Gefahren. Bedingt durch das Rechtsdienstleistungsgesetz darf NebenkostenPro keine formelle Rechtsberatung anbieten, sondern liefert lediglich Indizien und Muster-Widersprüche ohne bindende Vertretung. Zudem stoßen reine Sprachmodelle bei komplexen Sonderfällen – etwa einer gewerblich-privaten Mischnutzung – an ihre Grenzen.

Auf die berüchtigten „Halluzinationen“ von Sprachmodellen angesprochen, reagiert Falk pragmatisch. Er setze nicht auf ein einziges Modell, sondern auf eine spezialisierte Pipeline mit klar abgegrenzten Aufgaben. Die eigentliche Analyse basiere dann nicht auf Freitext-Antworten der KI, sondern auf einem präzisen Abgleich extrahierter Werte mit konkreten Gesetzestexten.

Zudem übt der Gründer Kritik an der generellen KI-Skepsis. „Was mich bei der Debatte um KI-Halluzinationen immer etwas stört: Wir tun so, als wäre das ein reines KI-Problem. In Wahrheit halluzinieren Menschen ständig“, kontert er. „Ein Sachbearbeiter, der zum dritten Mal an diesem Tag eine Abrechnung prüft, übersieht Fehler. Ein Vermieter, der seine Abrechnung in Excel zusammenbastelt, vertippt sich. KI lügt nicht strategisch, sie berechnet Wahrscheinlichkeiten.“

Um sich vor Regressansprüchen zu schützen, schiebt die Plattform die finale Verantwortung konsequent auf die Nutzer*innen ab. „Man muss mit KI genauso umgehen wie mit einem Kollegen. Den Output hinterfragen, nicht blind vertrauen“, mahnt Falk. Wer als Vermieter*in das Tool nutze, sei am Ende selbst für die Richtigkeit der eingegebenen Daten und das finale Dokument verantwortlich. „Bei komplexen Sonderfällen empfehlen wir ausdrücklich den Gang zur Fachberatung“, räumt er ein. Auch dem strengen Datenschutz bei Finanzdokumenten begegnet er kompromisslos: Daten kostenloser Nutzer*innen werden nach der Erstellung sofort gelöscht und alle Übertragungen werden strikt verschlüsselt.

David gegen die LegalTech-Goliaths

NebenkostenPro steht für den aktuellen Trend rund um gebootstrappte KI-Start-ups, bei denen ein(e) einzelne(r) Gründer *inmoderne Sprachmodelle nutzt, um teure menschliche Arbeitskraft zu kommoditisieren. Doch was hindert Branchenriesen mit riesigen Budgets daran, Falks Idee mittels offener KI-Schnittstellen einfach zu kopieren?

Falk gibt sich entspannt und räumt ein, dass die reine KI-Technologie kein echter Burggraben sei. Sein Vorteil liege im Domänenwissen und in der Agilität: „Als die CO2-Kostenaufteilung kam, hatte ich das schneller drin als die meisten etablierten Anbieter.“ Zudem bediene NebenkostenPro als einzige Plattform beide Marktseiten – sie prüft für die einen und erstellt für die anderen.

Am Ende, so ist sich der Gründer sicher, gewinne nicht derjenige mit dem größten Team, sondern der Schnellere. „Der Vorsprung entsteht nicht durch eine einmalige technische Idee, sondern dadurch, dass man jeden Tag nah am Nutzer baut und schneller iteriert als die Konkurrenz.“

ODONATAs Sprung zur Multi-Mission-Drohne

Vom scheiternden Lufttaxi-Traum zum taktischen Technologieträger: Das Münchner Start-up ODONATA hat mit dem PANTALA-Hovertest einen entscheidenden Pivot eingeleitet. Am 10. April 2026 erreichte das Unternehmen auf dem Militärflughafen der Bundeswehr im fränkischen Roth einen Meilenstein und absolvierte den ersten Schwebeflug des 1:1-Prototyps seiner Langstreckendrohne. Doch hinter der Erfolgsmeldung steckt eine tiefgreifende strategische Neuausrichtung des 2021 von Dennis Furchheim, Tobias Nickel und Dominik Weigl gegründeten Unternehmens. Wir haben uns mit Co-Founder Dennis Furchheim darüber ausgetauscht.

Gegründet im Jahr 2021 im Rahmen des ESA-Business-Incubation-Programms, verfolgten die ODONATA-Gründer Dennis Furchheim, Tobias Nickel und Dominik Weigl ursprünglich eine weitaus kapitalintensivere Vision: ein bemanntes, wasserstoffbasiertes Flugtaxi (eVTOL). Doch die Realität der Finanzmärkte zwang das Team zum Umdenken. „Die Finanzierung eines solchen Vorhabens ist grundsätzlich schon nicht einfach“, erinnert sich CEO Dennis Furchheim an die kritischen Phasen der letzten fünf Jahre.

Besonders die Probleme anderer Branchengrößen belasteten das junge Unternehmen: „Wenn aber die Entwicklungen, wie beispielsweise bei Lilium, einen in Sippenhaft nehmen, weil nicht unterschieden wird zwischen verschiedenen Konzepten, dann wird es noch härter.“ In dieser Situation habe der „Zeitenwechsel“ und der neue Fokus auf Dual-Use den nötigen Befreiungsschlag ermöglicht.

Mitte 2024 folgte der scharfe Kurswechsel weg vom zertifizierungsrechtlich komplexen Passagiermarkt. Furchheim räumt offen ein, dass dies auch eine Reaktion auf den Standort Deutschland war: „Wir haben ursprünglich mit dem Ziel gestartet, ein eVTOL für Passagiere zu entwickeln und zu produzieren. Wir haben allerdings lernen müssen, dass Investoren in Deutschland nicht in so langfristig angelegte Projekte investieren.“

Der Schwenk zur autonomen Drohne PANTALA sei zwar „hart“ gewesen, doch das Team konnte wertvolle Erfahrungen und Technologien aus der ersten Phase transferieren.

PANTALA: Technik mit Schwerpunkt-Trick

Die nun getestete PANTALA-Drohne ist als Multi-Mission-Plattform konzipiert, die Logistik, Lagebildgewinnung und Drohnenabwehr vereint. Mit einer Spannweite von 7,9 Metern und einem maximalen Startgewicht von 280 Kilogramm kann sie bis zu 80 Kilogramm Nutzlast transportieren. Dank einer hybriden Antriebsarchitektur – batterieelektrisch für Start und Landung, ein Kraftstoffsystem für den Reiseflug – soll sie über zehn Stunden in der Luft bleiben und eine Reichweite von mehr als 1.100 Kilometern erzielen.

Ein technologisches Highlight ist der zum Patent angemeldete verschiebbare Antriebsstrang, der die Schwerpunktsanpassung im Flug bei variierenden Lasten ermöglicht. Angesprochen auf die Zukunftsfähigkeit des Antriebs gibt sich der Gründer pragmatisch. „Wir haben uns bewusst technologieoffen aufgestellt“, betont Furchheim im Hinblick auf die noch fehlende Wasserstoff-Infrastruktur. Er verspricht: „So können wir mit klassischen Treibstoffen, elektrisch und künftig auch mit Wasserstoff fliegen, je nachdem, wie die Infrastruktur sich entwickelt.“

Der Marktdruck und die Konkurrenz

Obwohl ODONATA durch Partner wie die ESA und die TUM Venture Labs Aerospace unterstützt wird, bleibt der Kapitalbedarf massiv. Im Wettbewerb mit bereits etablierten Playern wie Quantum Systems muss sich das Start-up behaupten. Furchheim sieht sein Unternehmen jedoch technologisch im Vorteil.

„Wir haben zwei zentrale Vorteile“, erklärt der CEO selbstbewusst: „Zum einen haben wir eine höhere Payload mit bis zu achtzig Kilogramm, was uns ermöglicht, ganz neue Use-Cases zu bedienen.“ Zudem ermögliche die enorme Reichweite eine Überwachung von Frontabschnitten oder kritischer Infrastruktur über viele Stunden hinweg. Laut Furchheim gibt es bereits konkrete Gespräche mit Interessenten, „die genau auf so etwas warten“.

Zwischen Ethik und Skalierung

Die Ausrichtung auf den Sicherheitssektor bringt neben internationalem Interesse aus den USA, Indien oder der Ukraine auch strikte Rüstungsexportkontrollen mit sich. Auf die Frage nach den regulatorischen Hürden beim Export von Dual-Use-Gütern reagiert der Gründer zurückhaltend, deutet aber eine enge Abstimmung mit nationalen Stellen an. „Ohne zu viel zu verraten, wir sind im Gespräch mit der Bundeswehr, damit wir unser System auf diese Anforderungen hin optimieren“, erklärt Furchheim, räumt jedoch ein: „Aber es ist natürlich eine Hürde, die es nicht leichter macht.“

Der erfolgreiche Hovering-Test markiert den bisher wichtigsten Fortschritt. Der nächste entscheidende Lackmustest für ODONATA wird nun der aerodynamisch anspruchsvolle Übergang in den Reiseflug sein. Nur wenn dieser nahtlos gelingt, wird das System die wachsende internationale Nachfrage tatsächlich bedienen können.

PetTech-Start-up-Report 2026

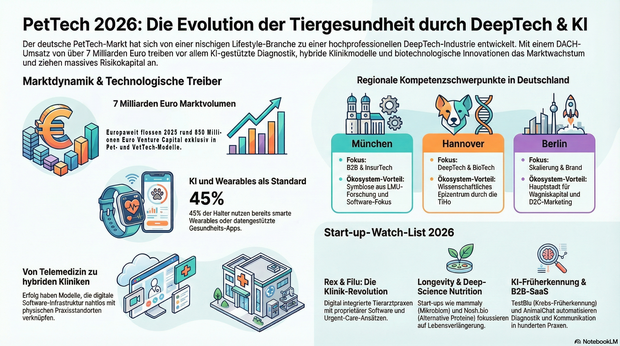

Wie DeepTech und KI den aktuellen PetTech-Markt prägen und welche Start-ups das Segment hierzulande dominieren. Plus: Die exklusive Start-up-Watch-List.

In den vernetzten De-Novo-Kliniken Berlins und Münchens scannen KI-Algorithmen heute in Millisekunden die MRT-Bilder von Haustieren, während personalisierte Longevity-Supplemente vollautomatisch an das Smart-Home der Halter geliefert werden. Der Vierbeiner des Jahres 2026 ist ein Premium-Patient und voll integrierter digitaler Lifestyle-Avatar, der eine hochkomplexe Gesundheitsökonomie antreibt. Venture-Capital-Fonds analysieren mittlerweile die Auslastungsquoten tierärztlicher Computertomographen genauso akribisch wie die wiederkehrenden Software-Umsätze im B2B-Sektor.

Wir blicken auf eine knallhart professionalisierte Industrie, in der radikale Effizienz und DeepTech den Takt angeben. Es geht um Algorithmen-gestützte Frühdiagnostik, hochskalierbare Praxis-Infrastrukturen und biotechnologische Nahrung – eine Ära, in der pure Tierliebe direkt auf tiefgreifende wissenschaftliche Innovation trifft und Investitionen in Milliardenhöhe rechtfertigt.

Ein hochreifer Milliardenmarkt unter KI-Einfluss

Der deutsche Markt für Heimtiere hat einen beispiellosen Reifegrad erreicht. Mit weit über 34 Millionen Haustieren allein in der Bundesrepublik sprechen wir von einem adressierbaren Markt, der längst nicht mehr nur Premium-Futter, sondern zunehmend hochpreisige Gesundheits- und Tech-Dienstleistungen konsumiert. Der technologische Haupttreiber im Jahr 2026 ist zweifelsohne die künstliche Intelligenz, dicht gefolgt von tiefen Integrationen des Internets der Dinge im Alltag der Tiere.

Laut einer aktuellen Bitkom-Studie nutzen mittlerweile über 45 Prozent der Halter*innen in Deutschland smarte Wearables oder datengestützte Gesundheits-Apps für ihre Tiere. Das spiegelt sich auch in den Bilanzen wider: Der Branchenumsatz im DACH-Raum hat die 7-Milliarden-Euro-Marke signifikant überschritten. Dabei flossen laut jüngsten Auswertungen von KfW Research im vergangenen Jahr europaweit rund 850 Millionen Euro Venture Capital exklusiv in Pet- und VetTech-Modelle.

Die neuen Treiber: Kliniken, Longevity und SaaS-Infrastruktur

Aktuell dominieren im PetTech-Sektor drei hochspezifische Sub-Sektoren den Markt. Allen voran steht der Bereich der De-Novo Vet-Tech-Kliniken. Hier verschmelzen physische Tierarztpraxen mit einer proprietären, durchdigitalisierten Software-Infrastruktur, die von der Terminbuchung bis zur KI-gestützten Diagnostik reicht. Etablierte Pioniere wie das Berliner Start-up Rex haben den Weg für diese hybriden Modelle geebnet.

Ein weiterer massiver Treiber ist die Pet-Longevity in Kombination mit DeepTech-Nutrition. Hier geht es nicht mehr um getreidefreies Futter, sondern um mikrobiom-basierte Nahrungsergänzungen und Alternative Proteine aus dem Bioreaktor, die das Leben der Tiere nachweislich verlängern sollen.

Der dritte dominierende Sektor ist B2B-Vet-SaaS. Start-ups bauen spezialisierte Software für Tierärzte, die Bilderkennung für Scans automatisiert und dem chronischen Fachkräftemangel in den Praxen entgegenwirkt.

Die geplatzten Träume der Solo-Telemedizin

Doch der Weg in dieses reife Marktumfeld war gepflastert mit schmerzhaften Lektionen. Der prominenteste Crash der jüngeren Vergangenheit war die spektakuläre Insolvenzwelle im Bereich der reinen Pet-InsurTechs und Solo-Telemedizin-Plattformen um das Jahr 2023 und 2024. Ein Paradebeispiel war das Berliner Neo-Versicherungs-Start-up Coya, das sich stark auf Tierversicherungen fokussiert hatte, vom französischen Konkurrenten Luko geschluckt wurde und letztlich in einem Insolvenzverfahren endete. Gleichzeitig verbrannten reine Tele-Vet-Apps, die ohne eigene physische Kliniken operierten, Millionen an VC-Geldern.

Aus diesen Debakeln lassen sich vier konkrete, fatale Fallstricke für heutige Gründer ableiten. Erstens die tödliche B2C-Kund*innenakquisitions-Falle: Wer heute im Pet-Bereich rein auf Performance-Marketing in sozialen Netzwerken setzt, wird von den astronomischen Customer Acquisition Costs erdrückt. Zweitens die Ignoranz gegenüber der Regulatorik, insbesondere der Gebührenordnung für Tierärzte. Der Gebührenschock der vergangenen Jahre brach Geschäftsmodellen das Genick, die diese Preissteigerungen nicht einkalkuliert hatten. Drittens das Dogma, dass Technologie den persönlichen Kontakt ersetzen kann: Haustiere können nicht ausschließlich über einen Bildschirm behandelt werden; wer keine physischen Anlaufstellen hat, scheitert an der Realität der Tiermedizin. Viertens die Vernachlässigung der Unit Economics zugunsten eines ungesunden Wachstums, was in einem Markt mit starker lokaler Bindung unweigerlich zum Cashflow-Kollaps führt.

Das deutsche PetTech-Netzwerk

Die deutsche PetTech-Landschaft hat sich auf wenige, aber extrem leistungsstarke Hubs konzentriert. München führt diese Liste unangefochten an. Mit der Ludwig-Maximilians-Universität, die eine der weltweit angesehensten tierärztlichen Fakultäten beheimatet, und dem InsurTech Hub Munich entsteht hier die perfekte Symbiose aus medizinischer Forschung und starkem B2B-Software-Fokus. Hannover verteidigt seinen Status als wissenschaftliches Epizentrum durch die Stiftung Tierärztliche Hochschule Hannover. Aus dem Umfeld dieser Elite-Forschungseinrichtung entspringen derzeit die tiefgreifendsten DeepTech- und BioTech-Ausgründungen der Branche. Berlin hingegen bleibt die unangefochtene Hauptstadt für Skalierung, Wagniskapital und D2C-Brandbuilding. Hier sitzen die großen Geldgeber*innen und Marketing-Genies, gestützt durch lokale Netzwerke. Leipzig komplettiert das Quartett als aufstrebender Star: Die Kombination aus der Veterinärmedizinischen Fakultät der Universität Leipzig und der BioCity, einem exzellenten Cluster für Biotechnologie, zieht zunehmend Start-ups an, die an der Schnittstelle von Tiergesundheit und Zellbiologie arbeiten.

Investor*innen-Radar

Das Kapital fließt heute intelligenter und zielgerichteter. Bei den spezialisierten VCs dominieren Fonds wie Five Seasons Ventures, die tiefes Verständnis für die Schnittstelle von FoodTech und Pet-Nutrition mitbringen, sowie global agierende Vehikel wie der Companion Fund. Im Bereich der Top-Tier Generalisten haben europäische Schwergewichte wie Cherry Ventures, Vorwerk Ventures und DN Capital den Sektor für sich entdeckt und pumpen beträchtliche Summen in hybride Klinik-Modelle und B2B-SaaS. Ein wesentlicher Machtfaktor sind mittlerweile die Corporate VCs der Industrie. Fressnapf dominiert mit seiner Beteiligungsgesellschaft die Früh- und Wachstumsphase strategisch, während Mars Petcare über seinen Arm Kinship massiv nach Europa drängt.

Der eigentliche Motor der Innovation liegt jedoch bei den Frühphasen-Motoren und Business Angels. Hier brillieren Köpfe wie Lukas Keindl, der als Gründer des US-Vorbilds Bond Vet nun aktiv sein Know-how und Kapital in die europäische Gründerszene pumpt, sowie spezialisierte Angel-Syndikate und Netzwerke wie der Auxxo Female Catalyst Fund, die gezielt diverse Gründungsteams in der Tiermedizin fördern.

Die Top-PetTech-Start-ups (Must-Watch)

Die nachfolgende Auswahl der Top Start-ups basiert auf einer strengen redaktionellen Analyse. Die zentralen Kriterien für die Aufnahme in dieses Ranking sind eine nachgewiesene Marktrelevanz durch messbares Praxis- oder Nutzerwachstum, ein hoher technologischer Reifegrad fernab reiner Konzeptphasen sowie das ausdrückliche Vertrauen namhafter Lead-Investoren. Um die aktuelle Innovationskraft des deutschen Ökosystems abzubilden, haben wir uns ausschließlich auf deutsche Start-ups konzentriert, deren Gründung im Jahr 2020 oder später erfolgte. Die Liste beleuchtet bewusst eine Diversität an Geschäftsmodellen, von B2B-Software über BioTech bis hin zu hybriden Versorgungskonzepten.

Rex

Das im Jahr 2021 von Julian Lechner und Jonathan Loesing gegründete Berliner Start-up Rex ist das aktuelle Paradebeispiel für moderne Tiermedizin. Rex kombiniert ein B2B/B2C-Hybrid-Modell und baut architektonisch anspruchsvolle, digital voll integrierte T Tierärzt*innenpraxen auf. Der USP liegt in der proprietären Praxismanagement-Software, die den Tierärzt*innen die Administration abnimmt, und der nahtlosen App-Experience für den Tierhalter. Das enorme Potenzial dieses Modells überzeugte Vorwerk Ventures, Picus Capital und weitere namhafte Investor*innen, die dem Unternehmen bereits zweistellige Millionenbeträge anvertrauten.

Filu

Ebenfalls angetreten, um den chronisch überlasteten Tierärzt*innenmarkt zu revolutionieren, ist das Münchner Start-up Filu. Gegründet 2022 von Anna Magdalena Naderer, Christian Köhler und Justus Buchen, positioniert sich das Unternehmen mit seinem Urgent-Care-Ansatz gekonnt zwischen klassischer Allgemeinpraxis und Notfallklinik. Die Kombination aus modernster Hardware vor Ort und smarten Tele-Triage-Prozessen im Hintergrund sorgt für eine extrem hohe Effizienz. Lead-Investoren wie DN Capital und YZR Capital haben das immense Skalierungspotenzial früh erkannt und die Expansionspläne befeuert.

mammaly

Im Bereich der D2C-Tiergesundheit setzt das 2020 in Köln von Stanislav Nazarenus und Alexander Thelen gegründete Start-up mammaly neue Standards. Das Geschäftsmodell basiert auf dem Direktvertrieb von hochwirksamen, mit Tierärzt*innen entwickelten Nahrungsergänzungsmitteln in Snackform. Der USP liegt in der tiefgreifenden Fokussierung auf das Mikrobiom von Hunden, um altersbedingte Beschwerden proaktiv zu lindern. Dieses datengetriebene und markenstarke Konzept sicherte mammaly unter anderem ein substanzielles Funding durch den spezialisierten VC Five Seasons Ventures.

PetLEO

Dieses 2020 in München von Karim Abdo und Bülent Hacioglu gegründete Unternehmen agiert als eine hochkomplexe B2B2C-Gesundheitsplattform. PetLEO verbindet Tierärzt*innen, Expert*innen und Haustierbesitzer*innen in einem geschlossenen, digitalen Ökosystem. Tierhalter*innen können Gesundheitsdaten verwalten, Giftköder-Warnungen erhalten und Termine buchen, während die Praxen selbst eine moderne Schnittstelle zur Kund*innenbindung erhalten. Das Start-up hat sich durch starke Partnerschaften mit Industrie und Versicherungen eine äußerst wehrhafte Marktposition als digitaler Alltagsbegleiter erarbeitet.

Hundeo

Dass man auch ohne massive externe Kapitalrunden im PetTech-Markt dominieren kann, beweist das 2020 von Enrico Bachmann in Berlin gegründete Start-up Hundeo. Das B2C-EdTech-Modell ist eine gamifizierte App für modernes Hundetraining. Der technologische USP ist die personalisierte, KI-gestützte Trainingsplanung, die sich dem Lernfortschritt des jeweiligen Tieres anpasst. Mit enormem organischem Wachstum und starker Nutzer*innenbindung gehört das gebootstrappte Hundeo zu den profitablen Vorzeige-Start-ups der App-Economy.

Nosh.bio

Obwohl nicht exklusiv für den Pet-Markt gegründet, rüttelt das 2022 von Tim Fronzek und Felipe Lino in Berlin ins Leben gerufene DeepTech-Start-up Nosh.bio die Tiernahrungsindustrie fundamental auf. Das B2B-Geschäftsmodell fokussiert sich auf die Herstellung von Alternativen Proteinen aus Pilzmyzel. Der technologische USP liegt in einem hocheffizienten Fermentationsprozess, der saubere, hochverdauliche und texturstarke Proteinquellen aus Pilzmyzel liefert. Als hochfunktionale „Clean-Label“-Zutat ermöglicht sie die Entwicklung erstklassiger, fleischfreier Tiernahrung – völlig ohne chemische Zusätze und ohne den massiven ökologischen Fußabdruck der konventionellen Fleischindustrie. Lead-Investor Earlybird unterstützt dieses zukunftsweisende BioTech-Modell.

TestBlu

Mit Gründung im Jahr 2022 in Potsdam bringt TestBlu echte Deep-Science in die tierärztliche Praxis. Das von Shahab Shoaei Matin geführte Geschäftsmodell ist ein KI-gestütztes B2B-SaaS-Produkt für Veterinärkliniken. Der USP des Unternehmens ist Deutschlands erster Bluttest zur Früherkennung von Krebs bei Hunden. Ein hochkomplexer Algorithmus analysiert Blutbilder auf Anomalien mit enormer Präzision. TestBlu positioniert sich als unverzichtbarer onkologischer Co-Pilot für Tierärzt*innen, um die diagnostische Sicherheit drastisch zu erhöhen.

AnimalChat

Die 2020 von Sebastian Wilkes und dem erfahrenen Tierarzt Dr. Heinrich Wilkes aus Borken gestartete B2B-Software AnimalChat hat das Problem der ineffizienten Kommunikation in Praxen radikal gelöst. Das Start-up bietet einen DSGVO-konformen, professionellen Messenger-Dienst speziell für Veterinär*innen und deren Klient*innen an. Der USP ist die nahtlose Integration von asynchroner Kommunikation und digitaler Wundverlaufskontrolle, ohne dass der Arzt bzw. die Tierärztin seine bestehende Praxissoftware austauschen muss. Dieses pragmatische, aber hochskalierbare Tool hat sich in hunderten Praxen als Standard etabliert.

Internationaler Ausblick & Fazit

Wer heute verstehen will, was morgen in Europa passiert, muss den Blick zwingend über den Tellerrand richten. Drei globale Makro-Trends werden den deutschen PetTech-Markt in Kürze massiv umwälzen. Aus den USA schwappt die Welle der Longevity-Pillen herüber, wo Start-ups bereits erste FDA-Zulassungen für Medikamente anstreben, die das biologische Altern von Hunden verlangsamen. Asien hingegen definiert den Standard für Hyper-Vernetzung neu: Hier sind smarte Katzentoiletten und vollautomatische, mit dem Smart-Home synchronisierte Futterautomaten, die Gesundheitsdaten in Echtzeit an den Tierarzt bzw. die -ärztin senden, bereits Massenmarkt. In Israel, dem weltweiten Hub für FoodTech, verschmilzt derweil AgriTech mit Tiernahrung. Kultiviertes Fleisch aus dem Labor für Premium-Tiernahrung steht dort nach der ersten regulatorischen Marktzulassung für Heimtierfutter in Großbritannien durch das Start-up Meatly endgültig vor dem globalen Durchbruch.

Das Fazit für 2026 ist eindeutig: Der Welpenschutz für Gründer*innen ist abgelaufen. PetTech ist ein knallhartes Business, das exzellente Unit Economics, tiefes regulatorisches Verständnis und echte technologische Alleinstellungsmerkmale verlangt. Investor*innen suchen heute nach Geschäftsmodellen, die reale Engpässe wie den Tierärzt*innenmangel lösen oder die Lebensspanne der Tiere durch harte Wissenschaft verlängern. Wer in diesem 20-Milliarden-Markt mitspielen will, muss beweisen, dass er/sie nicht nur Tiere liebt, sondern vor allem sein/ihr strategisches und technologisches Handwerk versteht.

cylibs Kampf um Europas Recycling-Krone

Mit über 140 Millionen Euro an eingeworbenem Kapital im Rücken und einer geplanten Industrieanlage im CHEMPARK Dormagen ist cylib derzeit einer der größten Hoffnungsträger im europäischen Batterierecycling. Nun übernimmt das 2022 von Paul Sabarny, Lilian Schwich und Dr. Gideon Schwich gegründete Aachener Start-up die Führung in einem strategischen Forschungskonsortium für die nächste Batterie-Generation: Natrium-Ionen-Akkus. Doch der Weg von der erfolgreichen Pilotlinie zur rentablen Großindustrie ist steinig – und die Konkurrenz im Kampf um Europas Rohstoffsouveränität formiert sich in Rekordzeit.

Im Jahr 2022 wurde cylib, das ganzheitliche Batterierecyclingunternehmen, in Aachen von Dr. Lilian Schwich (Co-CEO), Paul Sabarny (CTO) und Dr. Gideon Schwich (COO) als Spin-off gegründet. Das Kernteam hat seine technologischen Wurzeln tief in der Forschung an der RWTH Aachen University. Mit enormem Tempo zog das Team erste Pilotanlagen hoch: Bereits knapp neun Monate nach dem Einzug in die Hallen in Aachen Rothe Erde lief die erste Pilotlinie an, die rund 500 Kilogramm Batteriematerial pro Tag verarbeiten kann „Wir haben den Einzug in unsere heutige Recyclingstätte im Januar über den Aufbau der Infrastruktur bis hin zur Inbetriebnahme in weniger als 9 Monaten geschafft. Darauf sind wir im Team sehr stolz“, kommentiert CTO Paul Sabarny den rasanten Aufbau.

Heute, im April 2026, beschäftigt das Unternehmen über 120 Mitarbeitende. Durch Runden mit namhaften Investor*innen wie dem World Fund, 10x Founders, Vsquared Ventures, Porsche Ventures und Bosch Ventures hat das Unternehmen insgesamt über 140 Millionen Euro an Eigenkapital und öffentlichen Fördermitteln akquiriert.

Die Technologie und der Vorstoß bei Natrium-Ionen-Batterien

Das technologische Herzstück von cylib ist die sogenannte OLIC-Technologie (Optimized Lithium and Graphite Recovery). Im Gegensatz zu konventionellen, stark chemie- oder hitzegetriebenen Prozessen setzt cylib auf ein wasserbasiertes Verfahren zur Rückgewinnung. Das Start-up erzielt nach eigenen Angaben eine Recyclingeffizienz von über 90 Prozent für wertvolle Elemente wie Lithium, Graphit, Nickel, Kobalt und Mangan – bei einem um 80 Prozent reduzierten CO2-Fußabdruck im Vergleich zur primären Rohstoffgewinnung. Co-CEO Lilian Schwich betont diesen Ansatz: „Statt auf eine Vielzahl umweltschädlicher und gesundheitsgefährdender Chemikalien setzen wir in der Lithium und Graphit Rückgewinnung überwiegend auf Wasser.“

Aktuell bereitet das Team den Bau seiner ersten Industrieanlage im CHEMPARK Dormagen vor, die für eine jährliche Kapazität von bis zu 60.000 Tonnen (entspricht rund 140.000 Elektrofahrzeugbatterien) ausgelegt ist.

Nun erweitert das Unternehmen seinen Fokus: Cylib leitet fortan gemeinsam mit der Technischen Universität Braunschweig die Recyclingaktivitäten des 25-Partner-Konsortiums „SIB:DE“. Das vom Bundesministerium für Forschung, Technologie und Raumfahrt (BMFTR) mit 14,5 Millionen Euro geförderte Projekt läuft von März 2026 bis Februar 2029. Gemeinsam mit Schwergewichten wie VARTA, EDAG und acht Fraunhofer-Instituten soll Europas erstes industrielles Recyclingverfahren für Natrium-Ionen-Batterien entstehen. Für cylib übernehmen Till Gerlach (Head of R&D) und Lisa Pillar (Projektleiterin SIB:DE) die Verantwortung.

Das erklärte Ziel: Die Kreislaufwirtschaft soll direkt bei der Etablierung der neuen Technologie auf europäischen Märkten mitgedacht und Infrastruktur aufgebaut werden, bevor Altbatterien in großem Maßstab anfallen. Lilian Schwich bringt diese Vorreiterrolle auf den Punkt: „Wir warten nicht darauf, dass sich ausgediente Natrium-Ionen-Batterien ansammeln. Wir integrieren Kreislaufwirtschaft von Anfang an in die Technologie.“

Markt, Skalierung & Wettbewerb

So beeindruckend die technologische Basis und die Kapitalisierung sind, so komplex ist die Realität des Geschäftsmodells. Der Markt für Batterierecycling wird laut Schätzungen des Fraunhofer ISI bis 2040 in Europa auf rund 2,1 Millionen Tonnen anwachsen. Getrieben wird dies durch strenge EU-Regularien, die ab 2027 verbindliche Mindest-Recyclingquoten für kritische Rohstoffe fordern. Der Bedarf für cylibs Dienstleistung ist also zweifellos enorm.

Dennoch muss sich cylib massiven operativen und wirtschaftlichen Herausforderungen stellen:

- Die Hardware-Skalierungsfalle: Der Sprung von einer 500-kg-Tageskapazität auf 60.000 Tonnen pro Jahr im industriellen Maßstab erfordert eine beispiellose operative Exzellenz. Das Geschäft ist extrem kapitalintensiv (CapEx-lastig). Dass Hardware-Skalierung im Recycling tückisch ist, zeigte jüngst der internationale Player Li-Cycle, der bei der Skalierung in Nordamerika mit extremen Kostenüberschreitungen zu kämpfen hatte. Cylib muss beweisen, dass die Anlage in Dormagen nicht nur ökologisch, sondern auch auf Dauer margenstark und im Zeitplan funktioniert.

- Starker Wettbewerb: Cylib agiert keineswegs in einem Vakuum. Etablierte Akteure wie Duesenfeld betreiben in Deutschland bereits seit Jahren Recyclingverfahren auf mechanisch-thermodynamischer Basis. Im direkten Start-up-Ökosystem zieht das Münchner Unternehmen tozero stark an: Das CleanTech-Start-up hat jüngst ebenfalls enorme Skalierungsfortschritte gemacht, seine industrielle Demonstrationsanlage eröffnet und bereits erfolgreich recyceltes Lithium sowie Graphit für kommerzielle Kunden qualifiziert. Auf europäischer Ebene bauen zudem Giganten wie Northvolt (mit „Revolt“) mächtige Inhouse-Recycling-Kapazitäten auf. Der Kampf um die lukrative „Schwarzmasse“ (geschredderte Batterien) wird die Einkaufspreise für Start-ups in die Höhe treiben.

- Das Margen-Problem der Natrium-Technologie: Der Schritt in das Natrium-Ionen-Recycling (SIB) ist ökologisch sinnvoll, aber wirtschaftlich ein Balanceakt. Im Gegensatz zu Lithium-Ionen-Akkus kommen Natrium-Zellen ohne teure kritische Metalle wie Kobalt oder Nickel aus. Für das Recycling bedeutet das: Die extrahierten Materialien erzielen auf dem Rohstoffmarkt deutlich geringere Preise. Die chemische Rückgewinnung (hydrometallurgische Aufbereitung) droht hier unwirtschaftlich zu werden. Es ist daher eine zwingende Notwendigkeit, dass cylib im SIB:DE-Projekt einen dualen Ansatz verfolgt und das sogenannte Direktrecycling erforscht. Dabei werden Aktivmaterialien ohne vollständigen chemischen Aufschluss direkt in die Zellproduktion zurückgeführt. Zwar könnte das die Verarbeitungskosten insbesondere für Produktionsausschuss erheblich senken und die Materialqualität erhalten, jedoch ist die Demonstration im Pilotmaßstab erst für Anfang 2029 geplant. Bis sich dieses Verfahren wirtschaftlich selbst trägt, dürfte noch viel Zeit vergehen.

Fazit

Cylib hat sich durch tiefgreifende wissenschaftliche Expertise, eine aggressive und zugleich clevere Skalierungsstrategie und das Vertrauen großer Geldgeber*innen eine absolute Pole-Position erarbeitet. Mit der Etablierung des SIB:DE-Konsortiums festigt das Unternehmen zudem seinen Anspruch, als Vordenker der Branche zu agieren. Die eigentliche Bewährungsprobe steht Lilian Schwich und ihrem Team jedoch noch bevor: Das fehlerfreie Hochfahren der Industrieanlage in Dormagen in einem Umfeld, in dem die Wettbewerber*innen immer schneller werden. Nur wenn hier der operative Durchbruch gelingt, wird aus dem Versprechen echter Kreislaufwirtschaft ein tragfähiges europäisches Geschäftsmodell.

NBH-Systems: Zwischen Schaltschrank und Skalierbarkeit

Wie Dorian Tobollik und Timo Hartig mit ihrem Hardware-Start-up NBH-Systems eine Industrie-Nische knacken wollen.

Laptops, die prekär auf Maschinengehäusen balancieren, oder kniende Instandhalter*innen, die notgedrungen mit einer Hand tippen – der Arbeitsplatz im technischen Service ist selten ergonomisch. Aus genau diesem alltäglichen „Pain Point“ heraus ist das Start-up NBH-Systems entstanden. Wie Dorian Tobollik und Timo Hartig mit ihrem Hardware-Unternehmen eine Industrie-Nische knacken wollen, haben wir analytisch unter die Lupe genommen.

Vom Pain Point zum Produkt

Die Entstehungsgeschichte des hessischen Start-ups ist ein klassisches Lehrstück für anwendergetriebene Innovation. Dorian Tobollik, selbst langjähriger Systemtechniker, erlebte das Fehlen eines stabilen Arbeitsplatzes an Maschinen und Anlagen immer wieder als echten Effizienz- und Sicherheitskiller. Anstatt den Status quo hinzunehmen, ging er ans Reißbrett und entwickelte eigene Prototypen.

Doch der Weg zur Serienfertigung „Made in Germany“ barg Tücken. „Der Weg vom ersten Prototyp bis zur Serienfertigung war deutlich aufwendiger, als ich am Anfang gedacht habe“, räumt Tobollik rückblickend ein. Der große Vorteil lag jedoch in seiner eigenen Berufspraxis: „Die Idee kam direkt aus meinem Arbeitsalltag als Servicetechniker. Ich habe das Produkt selbst täglich im Einsatz gehabt, konnte es direkt testen und immer wieder anpassen.“

Die Teufel steckten bei der Umsetzung im Detail – von Gewicht und Größe über die Kompatibilität der Notebook-Formate bis hin zur exakten Stärke der Magnete. „Das sind Dinge, die man nicht am Schreibtisch löst, sondern nur im Alltag“, betont das technische Gehirn des Duos. Aus purer Überzeugung ließ er den vielversprechenden Ansatz direkt patentieren.

Um aus der funktionalen Erfindung ein marktfähiges Unternehmen zu formen, stieß Timo Hartig dazu. Er verantwortet als Geschäftsführer den Vertrieb und das Marketing, während Tobollik sich auf die Produktentwicklung fokussiert. Ende 2025 mündete dies in der Gründung der NBH-Systems UG im hessischen Seligenstadt.

Die Arbeitsteilung ist scharf getrennt, was unweigerlich die Frage nach internen Konflikten zwischen technischer Perfektion und straffen Vertriebszielen aufwirft. Hartig gibt sich hier pragmatisch: „Natürlich gibt es diesen klassischen Zielkonflikt zwischen technischer Perfektion und Marktdruck – aber wir lösen das sehr praxisnah. Für uns steht immer der reale Einsatz im Vordergrund.“ Die Entwicklungszyklen bleiben dabei extrem kund*innennah. Bis heute verzeichnet das Unternehmen laut dem Geschäftsführer keine einzige Retoure oder Reklamation. Neue Ansätze werden bewusst strukturiert angegangen und vorab mit ausgewählten Kund*innen getestet. „Am Ende entscheidet immer die Praxis. Wenn eine Lösung robust, einfach und zuverlässig funktioniert, ist sie marktfähig – und genau darauf liegt unser Fokus“, resümiert Hartig. Bootstrapping pur: Das Duo finanziert das Projekt vollständig selbst, produziert bewusst in Deutschland, arbeitet parallel in anderen Jobs und reinvestiert jeden verdienten Euro in die Firma.

Hardware-Fokus mit B2B-Preisschild

Das Kernprodukt nennt sich „MagFlex Pro“ – eine Notebook-Halterung, die werkzeuglos per Magnet oder industrieller Saugglocke an glatten Flächen oder Maschinen haftet. Mit einem Verkaufspreis von knapp 250 Euro und lokaler Fertigung platziert sich NBH-Systems selbstbewusst im B2B-Premium-Segment. Ein smarter Vertriebshebel: Ab zehn Stück gibt es Anpassungen im Corporate Design, was erfahrungsgemäß die Hemmschwelle für größere Flottenbestellungen senkt.

Doch das reine Hardware-Geschäft ist aus betriebswirtschaftlicher Sicht tückisch. Es gibt im Vergleich zur Softwarebranche keine stetigen Abo-Umsätze, das bewusst langlebige Produkt limitiert das lukrative Ersatzgeschäft, und die Skalierung erfordert hohe Vorfinanzierungen. Auf den kontinuierlichen Neukund*innendruck angesprochen, bestätigt Hartig die strategische Herausforderung: „Uns ist bewusst, dass ein reines Hardware-Geschäft kontinuierlich neue Kunden erfordert. Genau deshalb liegt unser aktueller Fokus klar auf Sichtbarkeit, Markenaufbau und darauf, unsere Lösung am Markt zu etablieren.“

Die Strategie im zu 90 Prozent B2B-getriebenen Kund*innenstamm setzt primär auf klassische Kanäle wie Direktvertrieb und den Ausbau von Großhändler*innen. Ein modulares Ökosystem entsteht dabei behutsam und streng nach Kund*innenwunsch: „Darauf aufbauend entwickeln wir Zubehör und Erweiterungen gezielt aus dem tatsächlichen Bedarf heraus. Für uns steht nicht Cross-Selling im Vordergrund, sondern ein echter Mehrwert im Einsatz.“ Auf das modische Schlagwort „Hardware-as-a-Service“ für Großkund*innen reagiert der Geschäftsführer noch zurückhaltend. Perspektivisch seien solche Modelle denkbar, aktuell zähle aber der Ausbau einer soliden Marktbasis im B2B-Umfeld.

Markt & Wettbewerb: Die Macht der Gewohnheit

Der anvisierte Markt für Außendienst- und Instandhaltungstechniker ist spitz, aber tief – nicht zuletzt, weil der chronische Fachkräftemangel die Budgets für Arbeitssicherheit und Effizienz lockert. Der härteste Konkurrent ist oft jedoch paradoxerweise kein globales Konkurrenzprodukt, sondern die blanke Improvisation. Wie knackt man also das Mindset von B2B-Einkäufer*innen, die für etwas zahlen sollen, das früher eine kostenlose (wenn auch wackelige) Kiste oder Ablagefläche erledigte?

„Die größte Herausforderung im Vertrieb ist tatsächlich weniger der Wettbewerb durch andere Anbieter, sondern die bestehende Gewohnheit. Viele Unternehmen haben sich über Jahre mit improvisierten Lösungen arrangiert“, weiß Hartig. Der stärkste Vertriebskanal des Start-ups ist daher das Produkt selbst, passend zum Slogan „Work Hands Free“. „In der Praxis steht ein Techniker am Schaltschrank oder an der Maschine, arbeitet mit dem MagFlex Pro – und Kollegen oder andere Beteiligte sehen das direkt“, erklärt Hartig den viralen Effekt am Einsatzort. Ein QR-Code auf der Halterung führt direkt zur Unternehmenswebsite, wodurch der Bedarf beim Anwender geweckt und in der Folge intern an den Einkauf weitergegeben wird.

Den exakten „Return on Investment“ (ROI) durch eingesparte Rüstzeiten datenbasiert zu beziffern, fällt dem Start-up hingegen schwer. Hartig räumt ein, dass sich Effekte wie strukturiertes Arbeiten und reibungslosere Abläufe nicht immer exakt in Zahlen pressen lassen. Dennoch sehe man in der Praxis, dass die Firmen zunehmend bereit sind, in solche Arbeitsbedingungen zu investieren.

Gegenüber globalen Giganten wie RAM Mounts und asiatischen Billigimporten muss NBH-Systems seinen USP – die authentische Historie von Technikern für Techniker gepaart mit der lokalen Produktion – daher als zwingendes Differenzierungsmerkmal glasklar nach außen kommunizieren.

Fazit: Solider Hidden Champion statt VC-Unicorn

NBH-Systems ist ein reinrassiges „Painkiller“-Start-up. Es löst ein reales, akutes Problem am Arbeitsplatz, anstatt als bloßes „Nice-to-have“ zu glänzen. Da Software-Komponenten oder Abo-Modelle fehlen, fehlt auch der klassische Hebel für exponentielles Hyperwachstum, der Venture-Capitalisten anlockt.

Das scheint das Gründer-Duo jedoch keineswegs zu stören. Sie wollen sich langfristig als Standard-Ausrüster in den Werkzeugkoffern großer Service-Flotten verankern und ein bodenständiges, hochprofitables KMU aufbauen. „Unser Fokus liegt klar auf einem soliden, nachhaltig wachsenden Unternehmen im B2B-Bereich. Wir bauen bewusst ein praxisorientiertes Hardware-Business auf und sehen uns nicht als klassisches Venture-Capital-Start-up“, unterstreicht Hartig die eigenen Ambitionen.

Man verkaufe derzeit vor allem im DACH-Raum sowie in den Niederlanden und Frankreich, peile aber als großen nächsten Schritt die weitere Internationalisierung an. Digitale Zukunftsfantasien für den Weg zum Industrie-Schwergewicht schließt er für später dennoch nicht aus: „Das bedeutet nicht, dass wir Themen wie IoT oder digitale Erweiterungen grundsätzlich ausschließen. Aktuell liegt unser Fokus aber klar darauf, unser bestehendes Produkt weiterzuentwickeln und weitere Anwendungsbereiche zu erschließen.“

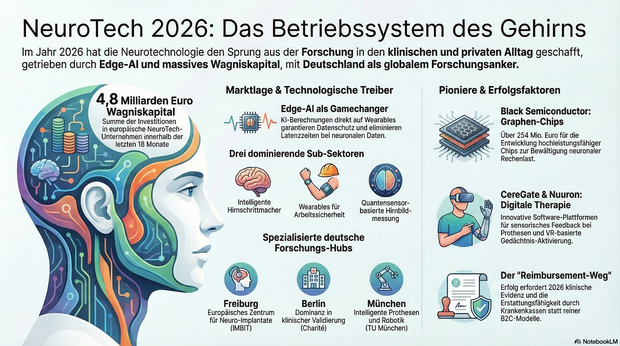

NeuroTech-Start-up-Report 2026

Das Betriebssystem des Gehirns: Wie NeuroTech die Grenze zwischen Mensch und Maschine auflöst und welche Start-ups dabei hierzulande federführend sind.

Der Moment, in dem eine gelähmte Person allein durch die Kraft ihrer Gedanken einen digitalen Cursor bewegt oder eine mechanische Prothese steuert, ist im Jahr 2026 längst kein Labor-Wunder mehr, sondern der Startpunkt einer industriellen Revolution. Wir befinden uns am Beginn des „Century of the Brain“. Pioniere wie das Münchner Scale-up munevo (gegründet 2018), das mit Smart-Glass-Steuerungen für Rollstühle Weltmarktführer wurde, oder die Freiburger Implantat-Spezialist*innen von CorTec (gegründet 2010), haben das technologische Fundament gegossen. Doch die neue Generation, die wir heute sehen, macht Neurotechnologie massentauglich und überführt sie aus der universitären Forschung in den klinischen und privaten Alltag.

Die Marktlage 2026

Der Markt hat 2026 eine neue Reifephase erreicht, maßgeblich getrieben durch Edge-AI. Bei dieser Technologie finden die komplexen KI-Berechnungen direkt auf dem Chip des Wearables statt, was Latenzzeiten eliminiert und die sensiblen neuronalen Daten lokal schützt. Branchenschätzungen auf Basis vergangener KfW-Innovationspanels deuten darauf hin, dass in den letzten 18 Monaten über 4,8 Milliarden Euro an Wagniskapital in europäische NeuroTech-Unternehmen geflossen sind. Zudem gehen Prognosen aus dem Umfeld von Branchenverbänden wie dem Bitkom davon aus, dass künftig jedes fünfte deutsche DeepTech-Start-up im Bereich Life Sciences neuronale Daten als Kernbestandteil seines Geschäftsmodells nutzen wird. Series-B-Runden unter 50 Millionen Euro sind bei technologischen Marktführer*innen mittlerweile die Ausnahme, da die regulatorischen Hürden der MDR (Medical Device Regulation) – der strengen EU-Verordnung für Medizinprodukte – enorme Kapitalpuffer für langwierige klinische Studien erfordern.

Jenseits von Neuralink: Die neuen Treiber der Branche

Drei technologische Sub-Sektoren dominieren das Jahr 2026. An vorderster Front steht die Closed-Loop-Neurostimulation, also „intelligente“ Hirnschrittmacher, die neuronale Biomarker in Echtzeit messen und Stimulationen (etwa bei Parkinson) nur dann auslösen, wenn das Gehirn sie wirklich benötigt. Ein weiterer Treiber sind Neuro-Wearables für die Arbeitssicherheit, die kognitive Überlastung messen, bevor menschliches Versagen zu Unfällen führt. Den dritten Block bildet das OPM-MEG (Optically Pumped Magnetometer-Magnetoencephalography). Diese neue Form der Hirnbildmessung nutzt Quantensensoren in leichten Helmen statt tonnenschwerer MRT-Geräte, um Demenz-Muster millimetergenau bei Raumtemperatur zu identifizieren.

Reality Check

Der Weg zum neuronalen Einhorn ist mit gescheiterten Hoffnungen gepflastert. Ein prominentes Mahnmal bleibt der Fall von Halo Neuroscience, die mit „Neuropriming“-Headsets für Sportler*innen einen Hype auslösten, aber letztlich an der mangelnden klinischen Evidenz scheiterten. Daraus hat die Branche vier fatale Fallstricke gelernt: Die Unterschätzung der klinischen Validierung, die Vernachlässigung der „Neuro-Ethics“ (Datensouveränität im Gehirn), das „Plattform-Paradoxon“ (Hardware ohne Software-Ökosystem) und der Versuch eines reinen B2C-Markteintritts ohne ärztliche Einbindung. Gründerinnen, die 2026 bestehen wollen, müssen den „Reimbursement-Weg“ über die Krankenkassen meistern.

Deutsche Brain-Hubs

Deutschland hat sich 2026 als globaler Forschungsanker etabliert. Freiburg bleibt durch das IMBIT das europäische Zentrum für Neuro-Implantate, während Berlin mit der Charité die klinische Validierung dominiert. München nutzt seine Stärke in der Robotik rund um die TU München für intelligente Prothesen, während in Karlsruhe am KIT ein Cluster für KI-basierte Diagnose-Algorithmen entstanden ist. Dresden fungiert derweil durch seine Mikroelektronik-Expertise als die „Werkbank“ für die hochspezialisierten Neuro-Chips der nächsten Generation.

Investor*innen-Radar

Die Finanzierungslandschaft ist 2026 hochgradig spezialisiert. Bei den VCs führen Fonds wie EQT Life Sciences (ehem. LSP) und Kurma Partners das Feld an, während Generalistinnen wie Lakestar oder HV Capital gezielt die Schnittstelle zwischen NeuroTech und generativer KI besetzen. Auf der Corporate-Ebene agieren die Investmentarme von Medtronic und Siemens Healthineers als strategische Anker. In der Frühphase sind es oft erfahrene Gründerinnen als Business Angels oder spezialisierte Syndikate wie die DeepTech Stars, die die ersten Millionen-Tickets lösen.

Diese NeuroTech-Start-ups solltest du 2026 auf dem Radar haben

Für die Auswahl der folgenden Start-ups wurden Unternehmen analysiert, die maximal sieben Jahre alt sind und mindestens TRL 6 (Technology Readiness Level 6) erreicht haben. Das bedeutet, die Technologie wurde bereits erfolgreich in einer klinisch relevanten Umgebung demonstriert. Weitere Kriterien waren die Patentdichte, die Validität des Geschäftsmodells sowie das Vertrauen führender MedTech-Investor*innen im Jahr 2025/26.

Black Semiconductor

Angeführt wird dieses Feld von Black Semiconductor aus Aachen, das 2020 von den Brüdern Dr. Daniel und Sebastian Schall gegründet wurde. Sie entwickeln Graphen-Chips – Halbleiter auf Basis von Kohlenstoff-Nanostrukturen, die Daten optisch übertragen und so künftig die enorme Rechenlast neuronaler KI bewältigen sollen. Ihr Geschäftsmodell basiert auf Deep-Tech-Hardware, gestützt durch eine Gesamtfinanzierung von über 254 Millionen Euro. Der Großteil davon (rund 229 Millionen Euro) stammt aus öffentlichen Förderprogrammen, ergänzt durch privates Kapital von Lead-Investor*innen wie Porsche Ventures und Project A. Gegenwärtig liegt der Fokus des Unternehmens auf der Validierung seiner neuen 300-mm-Wafer-Pilotfertigungslinie („FabONE“) in Aachen. Die Graphen-Technologie besitzt dabei das physikalische Potenzial, die Energieeffizienz und Übertragungsgeschwindigkeit gegenüber herkömmlichen Silizium-Chips massiv zu steigern.

CereGate

In München setzt CereGate, gegründet von Dr. Bálint Várkuti, neue Maßstäbe durch eine Software-Plattform, die Informationen direkt in das Gehirn „einschreibt“, um etwa sensorisches Feedback für Prothesen zu generieren. Ihr B2B-Software-Modell zielt auf Partnerschaften mit großen Implantat-Hersteller*innen ab und wird unter anderem von 468 Capital sowie re.Mind Capital unterstützt. Momentan bereitet das Team klinische Studien vor, um die strengen Anforderungen der europäischen Medizinprodukteverordnung (MDR) zu erfüllen. Ein zentraler Fokus liegt dabei auf der zukünftigen Behandlung von Parkinson-Gangstörungen, für die das Unternehmen mittelfristig eine entsprechende Zertifizierung und den Marktzugang anstrebt.

MindAhead

Den Bereich der Demenz-Prävention besetzt MindAhead aus Berlin, das 2022 unter anderem von Nina Kiwit und Pasquale Fedele ins Leben gerufen wurde. Ihre KI-Plattform zur Früherkennung und Verlangsamung kognitiven Abbaus wird durch den Roche-Partner RoX Health validiert. In dieser Phase konzentriert sich das Start-up auf die klinischen Studien für die offizielle Listung als dauerhafte DiGA (Digitale Gesundheitsanwendung). Ziel ist es, nach erfolgreicher Zulassung allen gesetzlich Versicherten in Deutschland einen direkten, auf Rezept erstattungsfähigen Zugriff auf die App zu ermöglichen.

Metis Neurotec

Ebenfalls auf Diagnostik fokussiert ist Metis Neurotec aus Karlsruhe, eine Gründung von Dr. Simon Stock und Marius Gerdes, deren Ursprünge ins Jahr 2021 zurückgehen. Das Spin-off des Karlsruher Instituts für Technologie (KIT) entwickelt eine KI-basierte Software-Plattform zur Demenzprävention. Statt auf EEG-Scans setzen sie auf die intelligente Analyse von individuellen Risikofaktoren und Alltagsdaten, um personalisierte Präventions- und Interventionspläne gegen kognitiven Abbau zu erstellen. Gegenwärtig steht die Weiterentwicklung und Validierung der Plattform im Vordergrund, um künftig als fundiertes digitales Werkzeug die präventive Versorgungskette – auch im ländlichen Raum – nachhaltig zu unterstützen.

Nuuron

Einen visionären Therapieansatz verfolgt das 2023 von Fabian Queisner und Dr. Markus Müschenich gegründete Berliner NeuroTech-Start-up Nuuron. Ihr digitaler „Memory Pacemaker“ zielt darauf ab, das Gedächtniszentrum über ultrahochfrequente visuelle Reize (VR/AR) zu aktivieren und soll künftig als digitale Therapie (DTx) zur Behandlung von Alzheimer-Demenz verschrieben werden. Mit dem kürzlich eingeworbenen Millionenkapital finanziert das Unternehmen nun groß angelegte Studien an der Berliner Charité sowie am Deutschen Zentrum für Neurodegenerative Erkrankungen (DZNE), um die gezielte Reaktivierung gedächtnisrelevanter Hirnwellen klinisch zu belegen und den Markteintritt vorzubereiten.

DeepSpin

Parallel dazu arbeitet DeepSpin aus Berlin, das 2020 von Clemens Tepel und Pedro Freire Silva gegründet wurde, an der Revolutionierung der medizinischen Bildgebung durch tragbare KI-MRT-Systeme. Unterstützt durch Investorinnen wie APEX Ventures entwickelt das Team eine völlig neue Architektur, die auf vereinfachte, kostengünstige Magnete setzt und die fehlende Hardware-Präzision durch hochkomplexe KI-Algorithmen ausgleicht. Das langfristige Ziel ist es, MRT-Scans extrem kostengünstig und mobil direkt zu den Patient*innen (Point-of-Care) zu bringen. Derzeit forciert das Spin-off die technologische Entwicklung und Validierung seiner Systeme, um den Weg für zukünftige klinische Einsätze und behördliche Zulassungen zu ebnen.

BrainGrade

In der Hauptstadt ansässig ist auch BrainGrade, das 2019 von Peter Schlecht gegründet wurde und durch den renommierten kalifornischen Biotech-Accelerator IndieBio gefördert wird. Das Neurotech-Start-up arbeitet an intelligenten Gehirnimplantaten zur kognitiven Neurostimulation, um den Abbau bei Alzheimer-Patientinnen gezielt zu verlangsamen. Das hochkarätig besetzte Team konzentriert sich momentan intensiv auf die technologische Entwicklung und präklinische Validierung der Systeme. Das langfristige Ziel ist es, die Sicherheit und Wirksamkeit dieser Implantate in künftigen klinischen Studien am Menschen zu belegen und so die Unabhängigkeit von Patientinnen deutlich zu verlängern.

Internationaler Ausblick & Fazit

Global erleben wir 2026 eine Verschmelzung von NeuroTech und Generativer KI, wobei die USA bei „Brain-to-Text“-Anwendungen für den Massenmarkt führen, während Asien massiv in staatlich gefördertes Brain-Monitoring im Bildungssektor investiert. Europa hat jedoch die historische Chance, bei der ethisch fundierten, medizinisch zertifizierten Neurotechnologie Weltmarktführer zu bleiben. 2026 ist das Jahr, in dem Neurotechnologie den „Ivory Tower“ der Universitätskliniken endgültig verlässt und im heimischen Medizinschrank ankommt. Für Gründer*innen und Investor*innen bedeutet dies: Der Hype ist vorbei, die Ära der harten klinischen und ökonomischen Beweise hat begonnen.

Die Müsli-Macher und die Kälte: Das neue Millionen-Projekt von Kraiss & Mahler

Dass sie Märkte revolutionieren können, haben die Freda-Gründer bereits bewiesen – nun steht die Tiefkühlkette auf dem Prüfstand. Mit einem mutigen Modul-Konzept fordern Philipp Kraiss und Christian Mahler die Industrie-Riesen im Supermarktregal heraus.

In der Start-up-Welt ist der Begriff Seriengründer*in oft ein zweischneidiges Schwert: Das Vertrauen der Investor*innen ist hoch, doch die Fallhöhe nach einem Erfolg wie mymuesli ebenso. Philipp Kraiss und Christian Mahler haben sich mit ihrem 2023 gegründeten Food-Start-up Freda bewusst gegen ein „Me-too-Produkt“ und für eine operative Wette auf die Zukunft der Tiefkühlkette entschieden. Mit einem mutigen Modul-Konzept fordern sie die etablierten Industrie-Riesen im Supermarktregal heraus. Die Prämisse: Der Markt für Tiefkühlkost (TK) wächst – auf über 22,6 Milliarden Euro im Jahr 2024 –, ist aber durch extremen Preisdruck und eine veraltete Produktlogik geprägt. Wir haben uns das Geschäftsmodell näher angesehen und die Gründer dazu befragt.

Pizza, Pasta, Gelato … und jetzt Blocks?

Die Pizza „Salami Sensation“ war für Freda der Türöffner. Mit dem Sieg bei Stiftung Warentest (2024) bewies das Team, dass es Qualität „kann“ und schuf einen starken USP. Strategisch ist Pizza jedoch kein leichtes Feld: Der Wettbewerb ist anspruchsvoll, die Regalplätze im Einzelhandel sind besetzt und die Differenzierung erfolgt meist über den Preis. Mit einer Innovation wie „Frozen Blocks“ erweitert Freda nun das Spielfeld und eröffnet eine neue Kategorie von Tiefkühlkost.

Es handelt sich dabei nicht mehr um ein fertiges Gericht, sondern um eine Systemkomponente. Das Konzept orientiert sich am gastronomischen „Mise en Place“: Vorbereitete, schockgefrostete Komponenten wie Beef Ragù oder Chili sin Carne fungieren als Basismodule für die heimische Küche. Strategisch gesehen erhöht dies die Wertdichte pro Kubikzentimeter im TK-Fach und verringert die Komplexität in der eigenen Produktion im Vergleich zu mehrkomponentigen Fertigmenüs.

Auf die Frage, ob der strategische Wechsel von der Pizza zu den „Frozen Blocks“ eine Flucht aus dem Commodity-Preiskampf der Pizza-Truhe hin zu einer proprietären Nische sei, widerspricht Philipp Kraiss. Vielmehr handele es sich um einen konsequenten Ausbau des Sortiments, denn Freda solle künftig den gesamten Alltag der Kund*innen abbilden – vom Frühstück bis zum Abendbrot. Das sei eben mehr als nur Pizza. „Unser Anspruch ist aber nicht nur Bekanntes besser zu machen – wie bei unserer Pizza, sondern auch neue Wege zu gehen“, stellt der Gründer klar. Die flexiblen Module seien auf diesem Weg der nächste logische Schritt. Er verspricht dabei maximale Vielfalt aus dem Gefrierfach, „denn jeder Block lässt sich vielfältig kombinieren.“

Die Retail-Herausforderung: Kaufland als Stresstest

Mit einer Basis von über 30.000 D2C-Kund*innen hat das Unternehmen bereits bewiesen, dass die Nachfrage nach seinen Produkten besteht. Um dieses Potenzial voll auszuschöpfen und die Margen zu stärken, wurde im August 2025 der Launch in 780 Kaufland-Märkten umgesetzt – ein strategischer Meilenstein, der die Reichweite massiv erhöht und über das Volumen des stationären Einzelhandels den Weg zu nachhaltigem, profitablem Wachstum ebnet – ohne aufwendigen Versand mit Isolierung und Trockeneis.

Hier zählt nun die Shelf Velocity (Abverkaufsgeschwindigkeit). Ein modulares System erfordert von der Kundschaft jedoch ein Umdenken: Man kauft kein fertiges Abendessen, sondern eine Zutat. Freda muss hier beweisen, dass der Mehrwert der Zeitersparnis am Point of Sale verstanden wird, bevor die harten Auslistungsmechanismen des Handels greifen.

Doch wie überzeugt man eine*n Einkäufer*in davon, dass ein modulares System mehr Flächenproduktivität bringt als die zehnte Sorte Standard-Lasagne? Christian Mahler kontert auf diese Retail-Frage mit einem anschaulichen Branchen-Vergleich: „Wir sind eben nicht die zehnte Lasagne. Eine klassische TK-Lasagne belegt viel Regalfläche, bedient genau einen Anlass und konkurriert mit neun anderen Lasagnen um denselben Kunden.“ Durch das kompakte Format und eine maximale SKU-Dichte der Blocks könne der Händler auf derselben Regalfläche mehrere Sorten listen und spreche damit dutzende Zubereitungsarten von der Bowl bis zum Curry an. Mahler zeigt sich selbstbewusst: „Wir eröffnen eine neue Kategorie statt in einer bestehenden zu kämpfen.“

Operative Exzellenz vs. bayerisches Handwerk

Ein weiterer Spagat wartet in der Produktion: Freda wirbt offensiv mit „Made in Bavaria“ und handwerklicher Herstellung. In der Start-up-Praxis beißt sich Handwerk jedoch oft mit Skalierung. Wer bundesweit fast 900 Supermärkte bedient, muss industrielle Prozesse beherrschen. Die Gefahr dabei ist offensichtlich: Wenn die Qualität durch die Masse sinkt, verliert Freda seinen wichtigsten USP. Gleichzeitig bleibt bei der exklusiven Zielgruppe, die bereit ist, für TK-Komponenten Premium-Preise zu zahlen, in Zeiten der Inflation die Frage der Preissensibilität bestehen.

Auf drohende Kapazitätsgrenzen angesprochen, räumt Philipp Kraiss ein, dass die Passauer Manufaktur zwar das Herzstück bleibe. „Aber wir waren von Anfang an ehrlich zu uns selbst: Eine Manufaktur skaliert nicht linear“, gibt der Seriengründer zu bedenken. Mit wachsendem Geschäft müsse man die Produktion auf breitere Schultern stellen und mit Partnern zusammenarbeiten. Sein Kernversprechen an die Kund*innen lautet dabei jedoch: „Wir lagern nicht die Rezeptur aus, sondern die Kapazität.“

Marktpsychologie: Convenience ohne Reue

Psychologisch besetzt Freda damit eine überaus geschickte Lücke. Die „Frozen Blocks“ nehmen der Käuferschaft zwar die Entscheidung für die aufwendige Kernkomponente ab, lassen das Gefühl des Selbstkochens durch das frische Ergänzen von Beilagen jedoch vollkommen intakt. Dies eliminiert die oft vorhandene „Convenience-Scham“ gesundheitsbewusster Zielgruppen und könnte die Lösung für die stagnierenden Marktanteile klassischer Fertiggerichte bei jüngeren Konsument*innen sein.

Fazit für die Start-up-Praxis