Aktuelle Events

Digitale Zettelwirtschaft: Gefahren durch Tool-Hoarding

Warum Unternehmen die Gefahren des sog. Tool-Hoardings nicht unterschätzen sollten und wie sie dem Problem effizient und effektiv vorbeugen können.

In einer zunehmend digitalisierten Geschäftswelt ist der Einsatz spezialisierter Software zu einer Selbstverständlichkeit geworden. Für nahezu jede betriebliche Aufgabe gibt es mittlerweile ein passendes Tool, das verspricht, die Effizienz und Produktivität zu steigern. Dabei kann jedoch die Ansammlung von zu vielen verschiedenen Anwendungen, das sogenannte Tool-Hoarding, Risiken mit sich bringen, die häufig übersehen werden. Diese digitale Zettelwirtschaft führt nicht nur zu Ineffizienz und höheren Kosten, sondern kann auch die Datenqualität und -sicherheit gefährden. Ein bewusster Umgang mit Tools und eine kluge Integration sind daher notwendig, um die eigentlichen Ziele der Digitalisierung – nämlich Prozessoptimierung und Effizienzsteigerung – zu erreichen. Doch was ist zu tun, um die Gefahren des Tool-Hoardings nicht zu unterschätzen bzw. dem Phänomen vorzubeugen?

Das Phänomen des Tool-Hoardings

Unter Tool-Hoarding versteht man die unkontrollierte Ansammlung verschiedener spezialisierter Softwarelösungen, die oft ohne eine ganzheitliche Strategie implementiert werden. In vielen Fällen beginnt das Phänomen dabei unauffällig und schleichend: Ein Unternehmen führt ein Tool für die Buchhaltung ein, ein weiteres für die Projektverwaltung, dann ein separates System für das Kundenmanagement und schließlich eine Lösung für die interne Kommunikation. Jedes dieser Tools ist für sich genommen sinnvoll, erfüllt eine spezifische Aufgabe und soll Arbeitsprozesse vereinfachen. Doch wenn immer mehr spezialisierte Anwendungen hinzugefügt werden, ohne dass sie effizient miteinander integriert sind, entstehen unerwartete Herausforderungen.

Die Gründe für das Entstehen von Tool-Hoarding sind dabei vielschichtig. Allem voran steht häufig jedoch der Wunsch, für jede Herausforderung das „beste“ oder „modernste“ Tool zu verwenden. Unternehmen möchten ihre Mitarbeitenden mit den neuesten technischen Lösungen unterstützen, in der Hoffnung, dass diese den Arbeitsalltag vereinfachen und die Produktivität erhöhen. Doch oft wird dabei übersehen, dass zu viele separate Systeme am Ende eher das Gegenteil bewirken können oder es fehlt generell an der kompletten Übersicht. Die Verwaltung einer Vielzahl von Tools kann dann sogar zur Belastung werden, insbesondere wenn die Systeme nicht miteinander kommunizieren oder Daten manuell übertragen werden müssen. Ein weiteres Problem ist die fragmentierte Datenhaltung, die zu Fehlern und Inkonsistenzen führt. Im schlimmsten Fall hat dann die zuerst gut gemeinte Anschaffung sogar einen gegenteiligen Effekt: Denn je mehr Tools ein Unternehmen im Einsatz hat, desto geringer ist die Wahrscheinlichkeit, dass sie tatsächlich genutzt werden.

Die versteckten Kosten des Tool-Hoardings

Neben der offensichtlichen organisatorischen Komplexität birgt Tool-Hoarding auch finanzielle Risiken, die oft nicht sofort ersichtlich sind. Denn jede Softwarelösung bringt nicht nur Lizenzkosten mit sich, sondern erfordert auch regelmäßige Wartung, Updates und Schulungen für die Mitarbeitenden. Diese Kosten summieren sich schnell, insbesondere in Unternehmen, die für unterschiedliche Aufgaben verschiedene Tools einsetzen.

Darüber hinaus können versteckte Kosten entstehen, die auf den ersten Blick nicht offensichtlich sind. Beispielsweise wird der Zeitaufwand für die Pflege mehrerer Systeme oft unterschätzt. Mitarbeitende müssen sich in jedes Tool einarbeiten, Daten zwischen verschiedenen Anwendungen synchronisieren und bei Problemen den IT-Support kontaktieren. Dies führt zu einem erheblichen administrativen Aufwand und Unkosten, die den eigentlichen Nutzen der Tools schnell übersteigen kann.

Sicherheits- und Datenschutzrisiken

Neben den organisatorischen und finanziellen Aspekten bringt Tool-Hoarding auch Sicherheitsrisiken mit sich. Je mehr Tools ein Unternehmen verwendet, desto größer ist die Angriffsfläche für Cyberkriminelle. Insbesondere in Branchen, in denen mit sensiblen Daten gearbeitet wird, wie im Personalwesen oder im Finanzsektor, stellt dies ein erhebliches Risiko dar. Jedes zusätzliche Tool bedeutet ein weiteres Einfallstor für potenzielle Angriffe. Unzureichende Passwortsicherheit, veraltete Softwareversionen oder mangelhafte Zugangskontrollen können dann dazu führen, dass sensible Daten ungeschützt bleiben.

Ein weiteres Sicherheitsproblem entsteht wiederum durch die Fragmentierung der Daten. Wenn verschiedene Tools nicht optimal integriert sind, besteht die Gefahr, dass wichtige Informationen in unterschiedlichen Systemen gespeichert werden, ohne dass diese ausreichend gesichert oder synchronisiert sind. Dies kann nicht nur zu Datenverlusten führen, sondern auch die Einhaltung von Datenschutzbestimmungen erschweren. Insbesondere in Zeiten strengerer Datenschutzgesetze, wie der DSGVO, ist es für Unternehmen von entscheidender Bedeutung, den Überblick über ihre Daten zu behalten und sicherzustellen, dass diese jederzeit geschützt sind.

HR-Software als Beispiel für die Auswirkungen von Tool-Hoarding: Fluch oder Segen?

Ein besonders anschauliches Beispiel für das Problem bietet aktuell in vielen Firmen der HR-Bereich. Viele Unternehmen setzen insbesondere hier noch auf verschiedene Einzellösungen für Recruiting, Personalverwaltung, Schichtplanung, Zeiterfassung und Lohnabrechnung. Während jedes dieser Tools für sich genommen seine Funktion erfüllt, führt die parallele Nutzung oft zu den bereits genannten Herausforderungen. Beispielsweise müssen Personalabteilungen Daten manuell in verschiedene Systeme eingeben, da diese nicht ausreichend miteinander vernetzt sind. Das Ergebnis: Zeitverschwendung, höhere Fehleranfälligkeit und Frustration bei den Mitarbeitenden. HR-Verantwortliche tun also gut daran, sich vor der schlussendlichen Auswahl eines Tools einige Fragen zu stellen und vorhandene System zu hinterfragen: Werden die Daten der Zeiterfassung nahtlos in die Lohnabrechnungssoftware übertragen? Werden Urlaubs- und Krankheitsanfragen in der Schichtplanung berücksichtigt?

Gerade für Unternehmen, deren Mitarbeitende nicht klassisch am Schreibtisch zu finden sind, stellt zudem die Mobilfähigkeit der genutzten Software ein absolutes Muss dar. Denn oftmals haben Mitarbeitende in diesen Branchen nur über mobile Endgeräte wie Smartphones Zugang zu den Tools, sodass nicht mobil-optimierte Anwendungen schlichtweg nicht genutzt werden. Die Folge: Die erhoffte Effizienzsteigerung durch die Einführung der digitalen Lösungen bleibt ganz einfach aus.

Der Weg aus der Tool-Harding-Falle: Integration und Automatisierung

Unternehmen sollten demnach ihre Softwarelandschaft regelmäßig überprüfen und rationalisieren, um den negativen Auswirkungen des Tool-Hoardings zu entgehen. Anstatt für jede Aufgabe ein separates Tool zu verwenden, ist es oft sinnvoller, eine integrierte Lösung zu wählen, die mehrere Funktionen abdeckt. Dies reduziert nicht nur die Anzahl der verwendeten Tools, sondern erleichtert auch die Datenverwaltung und sorgt für eine einheitliche Benutzererfahrung.

Sind wiederum schon Tools vorhanden, auf die es aufzubauen gilt, ist dann wiederum ein zentraler Punkt die Integration neuer Lösungen in die vorhandenen Systeme. Eine nahtlose Datenübertragung zwischen den Tools und eine zentrale Verwaltung der Informationen sind entscheidend, um den administrativen Aufwand zu minimieren und gleichzeitig die Datensicherheit zu erhöhen. Unternehmen, die auf integrierte Plattformen setzen, profitieren von einem besseren Überblick über ihre Prozesse und können schneller auf Veränderungen reagieren. Generell gilt jedoch: Wenn zwei Tools durch eines ersetzt werden könnten, lohnt es sich oft, diese Möglichkeit zu prüfen.

Schlussendlich spielt dann auch die Automatisierung von Prozessen eine immer größere Rolle bei der Reduzierung des Tool-Hoardings. Mithilfe von künstlicher Intelligenz (KI) können Routineaufgaben wie die Dateneingabe oder die Verwaltung von Benutzerzugängen automatisiert werden, sodass weniger manuelle Eingriffe erforderlich sind. Dies entlastet nicht nur die Mitarbeitenden, sondern verringert auch die Notwendigkeit zusätzlicher Tools.

Fazit: Klasse statt Masse

Tool-Hoarding ist eine der unterschätzten Herausforderungen der digitalen Transformation. Unternehmen, die eine Vielzahl spezialisierter Softwarelösungen anhäufen, riskieren, dass die vermeintliche Effizienzsteigerung durch diese Tools in einem unübersichtlichen, ineffizienten Softwaredschungel verpufft. Um diesem Problem entgegenzuwirken, ist es wichtig, die eingesetzten Tools regelmäßig zu evaluieren und sicherzustellen, dass diese optimal integriert sind. Weniger ist hier oft mehr: Eine konsolidierte Softwarelandschaft, die alle wichtigen Funktionen abdeckt, sorgt dann nicht nur für eine bessere Übersicht, sondern senkt auch die Kosten und erhöht die Sicherheit. Unternehmen, die also frühzeitig auf integrierte, benutzerfreundliche Plattformen setzen, können die Effizienz ihrer Prozesse nachhaltig steigern und die Gefahren des Tool-Hoardings vermeiden. Denn letztendlich geht es bei der Digitalisierung nicht darum, möglichst viele Tools zu verwenden, sondern eben die richtigen.

Der Autor David Padilla ist Gründer und CEO von Kenjo, Anbieter einer HR-Software für Arbeitskräfte bzw. Mitarbeitende in Unternehmen, die nicht an einen Schreibtisch gebunden sind und New Work effizient praktizieren wollen.

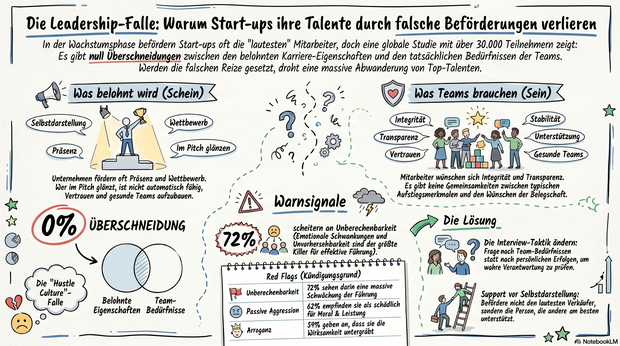

Die Leadership-Falle im Start-up

Laute Blender statt echter Leader? Warum im Start-up oft die falschen Leute befördert werden – und wie du teure Kündigungen deiner Top-Talente verhinderst.

Dein Start-up wächst, und du musst Verantwortung abgeben. Wenn es darum geht, die ersten Teamleads zu ernennen, fällt deine Wahl wahrscheinlich auf die Personen, die am lautesten „Hier!“ schreien, vor Selbstbewusstsein strotzen und in Pitches glänzen. Doch Vorsicht: Eine weltweite Studie von Hogan Assessments zeigt, dass eine erhebliche Diskrepanz zwischen dem besteht, was Unternehmen bei Führungskräften belohnen, und dem, was Mitarbeiter*innen tatsächlich wollen. Genau jene Eigenschaften, die Führungskräften helfen, die Karriereleiter zu erklimmen, treiben Mitarbeiter*innen möglicherweise gleichzeitig in die Flucht.

In der frühen Phase eines Start-ups ist dein Kernteam dein wichtigstes Kapital. Jede Abwanderung bedeutet den Verlust von wertvollem Wissen und bremst das Wachstum. Die Studie „The Leadership Divide: Global Insights on Who Leads vs. Who Should“ deckt in diesem Zusammenhang auf: Es gibt keinerlei Überschneidungen zwischen den wichtigsten Eigenschaften, die Führungskräfte an den Tag legen, und den Eigenschaften, die sich Mitarbeiter nach eigenen Angaben tatsächlich von ihnen wünschen.

Für diese Erkenntnis wurden die Persönlichkeitsdaten von mehr als 21.000 Führungskräften und die Antworten von 9.794 Mitarbeiter*innen aus 25 Ländern ausgewertet. Das Ergebnis sollte für alle Gründer*innen ein Weckruf sein.

Die „Hustle Culture“-Falle: Worauf wir fälschlicherweise achten

Gerade in Start-ups, in denen Pitching und schnelles Wachstum zum Alltag gehören, lassen wir uns oft vom falschen Typus blenden. Führungskräfte zeichnen sich laut den Daten in der Regel durch Selbstbewusstsein, Präsenz, Wettbewerbsfähigkeit und Selbstdarstellung aus. Unternehmen neigen seit jeher dazu, genau diese Aspekte wie Präsenz, Selbstbewusstsein und Ehrgeiz bei Führungskräften zu belohnen.

Das Problem: Organisationen belohnen damit oft eher das reine Hervortreten von Führungskräften – also Personen, die sich durch ihr Auftreten auszeichnen –, anstatt auf ihre tatsächliche Führungskompetenz zu schauen. Wer sich so verhält, ist nicht automatisch in der Lage, Vertrauen aufzubauen und gesunde Teams zu schaffen.

Der Realitäts-Check: Was dein Team wirklich braucht

Wenn du eine Führungskultur aufbauen willst, die Top-Talente bindet, musst du umdenken. Mitarbeiter legen überwiegend Wert auf Kommunikation, Integrität, Verantwortungsbewusstsein und fundierte Entscheidungsfindung. Es besteht eine wachsende Kluft zwischen den intern belohnten Eigenschaften und den tatsächlichen Erwartungen des Teams: Mitarbeiter*innen erwarten zunehmend Konsequenz, Transparenz, Verantwortungsbewusstsein und klare Kommunikation.

Kurz gesagt: Teams wollen Führungskräfte, denen sie vertrauen können, die klar kommunizieren und die die Voraussetzungen für den gemeinsamen Erfolg schaffen.

Red Flags: Die 4 größten Treiber für Kündigungen

Eigenschaften, die mit einer starken Führungspräsenz in Verbindung gebracht werden, können das Vertrauen der Belegschaft erschüttern und zu Unzufriedenheit führen, wenn sie nicht im Zaum gehalten werden. Achte bei Beförderungen auf diese Warnsignale, die von Mitarbeiter*innen als größte Probleme genannt wurden:

- Arroganz und Überlegenheitsgefühle: Während Durchsetzungsstärke beim Aufstieg oft hilft, geben 59 % der Beschäftigten an, dass Arroganz die Führungswirksamkeit deutlich untergräbt.

- Unberechenbarkeit: Start-ups sind oft chaotisch – umso wichtiger ist Stabilität an der Spitze. Emotionale Schwankungen sind ein großes Problem am Arbeitsplatz. 72 % geben an, dass unvorhersehbares Verhalten die Führungsstärke massiv schwächt.

- Passive Aggression: 62 % der Befragten sehen passiv-aggressives Verhalten als schädlich für die Teamleistung und die Arbeitsmoral an.

- Zu langes Zögern: Auch das Gegenteil von lautem Auftreten ist gefährlich. Übermäßige Vorsicht oder Unentschlossenheit werden von 56 % als schädlich für das Team angesehen.

Deine Praxis-Strategie: So vermeidest du teure Fehlentscheidungen

Vertrauen, Verantwortungsbewusstsein und ein gesundes Urteilsvermögen sind keine zweitrangigen Eigenschaften. Sie sind entscheidend für die Effektivität des Teams und die langfristige Leistungsfähigkeit. Wie findest du diese Eigenschaften in der Praxis?

1. Passe deine Führungspipeline an

Führungskräftepipelines sind dann am stärksten, wenn du die Art und Weise, wie du Kandidaten identifizierst und förderst, auf das abstimmst, was die Mitarbeiter*innen tatsächlich schätzen. Befördere nicht automatisch den/die lauteste(n) Verkäufer*in zum Teamlead, sondern die Person, die andere am besten unterstützt.

2. Stelle im Interview die richtigen Fragen

Statt zu fragen: "Was sind deine größten Erfolge?" (fördert Selbstdarstellung), frage lieber:

- "Erzähle mir von einer Entscheidung, bei der du die Bedürfnisse deines Teams über deine eigenen Ziele gestellt hast." (Testet Verantwortungsbewusstsein).

- "Wie gehst du vor, wenn du eine wichtige Entscheidung unter hoher Unsicherheit treffen musst?" (Testet fundierte Entscheidungsfindung und schließt Unentschlossenheit aus).

- "Wie stellst du sicher, dass dein Team dir vertrauen kann, wenn es mal schlecht läuft?" (Fokus auf Kommunikation und Integrität).

3. Teste die emotionale Stabilität unter Druck

Da unberechenbares Verhalten ein großes Problem darstellt, solltest du in der Probezeit für eine neue Führungskraft genau beobachten, wie sie bei Stress reagiert. Wer hier unberechenbar wird oder passiv-aggressiv agiert, wird auf Dauer deine besten Mitarbeiter*innen vertreiben.

Fazit

Wahre Leader in einem Start-up müssen nicht die lautesten im Raum sein. Wenn du auf Leute setzt, die Konsequenz und Transparenz mitbringen und gesunde Teams aufbauen, sparst du dir hohe Recruiting-Kosten durch Fluktuation und stellst die Weichen auf nachhaltiges Wachstum.

„Wir scheitern nicht an der Technologie, sondern an der Kommerzialisierung“

Warum wandern Europas DeepTech-Gründer*innen ab? Wie viel Schuld trägt das europäische Ökosystem daran – und wie viel die Gründer*innen selbst? Im Interview: Dr. Martin Schilling, Ex-N26-COO und CEO von Deep Tech Momentum, über fehlendes Risikokapital, mangelnde Traktion und den schweren Weg zur Skalierung.

Deutschland und Europa sind starke Quellen für DeepTech-Innovationen – aus Universitäten, Forschungseinrichtungen, Patenten und technischer Domänenexpertise. Dass wir hier in der Spitzenliga spielen, belegen Studien wie das European Innovation Scoreboard, des Europäischen Patentamts und der Max-Planck-Gesellschaft regelmäßig. Dennoch stehen wir vor einem massiven Problem: Es mangelt nicht an Innovationen selbst, sondern an ihrer Kommerzialisierung. Im Vergleich zu den USA, wo Investor*innen häufig früher und mit höherer Risikobereitschaft auf große technologische Wetten setzen, finden europäische Start-ups zu spät Kund*innen, Traktion und risikofreudiges Kapital. Weil Kommerzialisierung, Industrialisierung und Wachstum hierzulande oft langsamer verlaufen, entsteht für viele Gründer*innen ein struktureller Druck, Kapital und Skalierung in den USA zu suchen.

Einer, der diese Lücke an der Schnittstelle von Gründer*innen, Kapital und Unternehmenskunden aus erster Hand beobachtet, ist Dr. Martin Schilling. Der ehemalige COO von N26 und Managing Director von Techstars Berlin ist heute Co-Founder und CEO von Deep Tech Momentum (DTM). DTM ist Europas führende Plattform für DeepTech und AI Innovation, findet vom 20. bis 21. Mai 2026 in Berlin statt und bringt Unternehmen als potenzielle Kund*innen, DeepTech-Start-ups als Anbieter*innen und Investor*innen aktiv zusammen.

Wir wollten von Martin Schilling erfahren: Wie viel Schuld trägt das europäische Ökosystem an der geschilderten Misere – und wie viel die Gründer*innen selbst?

StartingUp: Martin, du stellst die These auf, es mangele in Europa nicht an DeepTech-Innovationen, sondern an der Kommerzialisierung. Machen wir es uns damit nicht zu einfach? Müssten wir nicht ehrlicherweise auch über die katastrophal langsamen IP-Transfer-Prozesse an deutschen Universitäten, überregulierte Märkte und den Fachkräftemangel sprechen, die Start-ups schon abwürgen, bevor sie überhaupt etwas kommerzialisieren können?

Martin Schilling: Ich glaube, wir dürfen uns hier nichts vormachen. Natürlich haben wir in Europa strukturelle Probleme wie langsame IP-Transfer-Prozesse, fragmentierte Märkte, Regulierung, Fachkräftemangel. Das alles ist real und bremst viele Entwicklungen aus. Aber diese Faktoren erklären nicht vollständig, warum wir trotz exzellenter Forschung so selten globale Kategorie-Gewinner hervorbringen.

Der entscheidende Punkt ist aus meiner Sicht ein anderer: In Europa denken wir Technologie oft zu lange aus der Perspektive der Forschung und zu spät aus der Perspektive des Marktes. In den USA wird viel früher gefragt: Wer zahlt dafür? Wie schnell kommen wir in echte Deployment-Szenarien? In Europa fragen wir zu lange, ob die Technologie perfekt ist. Das führt dazu, dass viele DeepTech-Start-ups zu spät mit echten Kunden interagieren, zu spät lernen und zu spät Traktion aufbauen. Die strukturellen Themen sind ein Teil des Problems. Aber die Art, wie wir Unternehmen bauen und die fehlende frühe Kommerzialisierungslogik sind aus meiner Sicht größere Hebel.

StartingUp: Du hast als COO bei N26 massives Wachstum miterlebt – ein B2C-FinTech mit einer App. DeepTech bedeutet aber oft jahrelange Forschung, Hardware-Entwicklung, Patente und B2B-Sales-Zyklen, die ewig dauern. Wie viel B2C-Wachstums-Mindset lässt sich überhaupt auf hochkomplexe DeepTech-Unternehmen übertragen, ohne an der Realität zu scheitern?

Martin Schilling: Man kann DeepTech nicht wie ein B2C-FinTech skalieren. Das wäre naiv. Die Zyklen sind länger, die Kapitalintensität höher, und die technische Unsicherheit ist real. Aber das heißt nicht, dass man auf ein Wachstums-Mindset verzichten kann. Was übertragbar ist, sind nicht die Taktiken, sondern die Prinzipien: Geschwindigkeit im Lernen, radikale Kundenorientierung und der Anspruch, früh zu skalieren und nicht erst, wenn alles perfekt ist.

Was ich oft sehe ist, dass DeepTech-Teams jahrelang die Technologie optimieren, bevor sie ernsthaft in den Markt gehen. In dieser Zeit verlieren sie wertvolle Iterationen. Die besten Teams denken von Anfang an in Dual Tracks: Technologie entwickeln und parallel kommerzielle Hypothesen testen. Das bedeutet nicht, dass man Hardware-Zyklen beschleunigen kann. Aber man kann sehr wohl beschleunigen, wie schnell man versteht, wo echter Bedarf ist und wie Zahlungsbereitschaft entsteht.

StartingUp: Ein ständiger Kritikpunkt ist, dass der Zugang zu mutigem Kapital in Europa langsamer funktioniert als in den USA. Aber VCs sind keine Wohlfahrtsverbände, sie rechnen Risiko und Rendite durch. Müssen wir nicht vielleicht zugeben, dass viele europäische DeepTech-Cases geschäftlich einfach nicht attraktiv oder zu schlecht gepitcht sind, um ein amerikanisches Risikoprofil anzuziehen?

Martin Schilling: Es ist zu einfach, alles auf fehlendes Kapital zu schieben. Ja, die USA haben mehr Kapital und mehr Risikoappetit. Aber Kapital folgt am Ende immer überzeugenden Geschichten und vor allem überzeugender Traktion. Was ich in Europa oft sehe: Technologisch brillante Teams, aber schwache Positionierung, unklare Go-to-Market-Strategien und zu wenig Fokus auf kommerzielle Meilensteine. Viele Pitches sind technisch beeindruckend, aber beantworten nicht die entscheidende Frage, warum aus etwas ein erfolgreiches Geschäftsmodell wird. Das heißt nicht, dass es kein strukturelles Kapitalproblem gibt. Das gibt es. Aber wir müssen genauso ehrlich sagen: Ein Teil des Problems liegt in der Art, wie wir DeepTech-Unternehmen bauen und erzählen.

StartingUp: Du beobachtest somit, dass deutsche Start-ups oft nicht an der Technologie, sondern an Marktanbindung und Traktion scheitern. Wenn die Technologie exzellent ist, scheitert es dann am Menschlichen? Wie oft erlebst du, dass brillante Forschende aus Eitelkeit nicht loslassen können und sich weigern, den CEO-Posten an erfahrene Business- und Sales-Profis abzugeben?

Martin Schilling: Das Thema gibt es, aber ich würde es differenzierter sehen. DeepTech entsteht oft aus wissenschaftlicher Exzellenz. Und diese Gründer*innen bringen etwas extrem Wertvolles mit: tiefes Verständnis, langfristiges Denken und eine hohe technische Vision. Die Herausforderung entsteht, wenn diese Stärken nicht durch kommerzielle Kompetenz ergänzt werden. Ich erlebe weniger ein klassisches „Ego-Problem“, sondern eher ein Rollenproblem, denn viele Gründer*innen haben nie gelernt, was es bedeutet, ein Unternehmen zu skalieren. Das gilt insbesondere im B2B-Kontext. Die besten Teams lösen das sehr pragmatisch. Sie bauen früh komplementäre Führungsteams mit starkem Sales-, Operations- und Marktverständnis auf. Ob das dann ein externer CEO ist oder nicht, ist zweitrangig. Entscheidend ist, dass die Organisation die Fähigkeiten hat, nicht nur Technologie zu entwickeln, sondern sie auch zu verkaufen.

StartingUp: Um Start-ups, Corporates und Investor*innen zusammenzubringen, veranstaltest du im Mai das Event Deep Tech Momentum in Berlin. Aber ganz ehrlich: Es gibt in Europa und Deutschland bereits hunderte Start-up-Konferenzen, Summits und Matchmaking-Events. Warum sollte ausgerechnet ein weiterer Marktplatz das tiefgreifende strukturelle Problem lösen, dass die deutsche Industrie oft schlichtweg zu risikoavers ist, um bei jungen Start-ups einzukaufen?

Martin Schilling: Ich stimme dir zu. Es mangelt nicht an Events in Europa, wir haben eher zu viele davon. Der Unterschied bei Deep Tech Momentum ist, dass wir kein klassisches Konferenzformat sind, sondern ein Marktplatz. Was heißt das konkret? Wir bringen nicht einfach Leute zusammen, sondern orchestrieren konkrete Interaktionen zwischen Start-ups, Corporates und Investor*innen. Dabei verfolgen wir das klare Ziel, Deals, Partnerschaften und Deployment zu schaffen.

Bei Deep Tech Momentum kommen über 3.000 Senior Entscheider*innen zusammen. Über den Marktplatz wurden bereits mehr als 500 Millionen Euro an Investitionen und hunderte Partnerschaften angestoßen. Unser Ziel bis 2030 ist es, 100 Milliarden Euro zusätzliche DeepTech-Investitionen zu mobilisieren und 10.000 Partnerschaften zwischen Start-ups und Industrie zu ermöglichen.

Ein Beispiel ist unser Guardian Program. Dort bringen wir die Top 300 Senior Innovation Leaders aus führenden Unternehmen gezielt mit vorqualifizierten DeepTech-Start-ups zusammen, also mit Unternehmen, die echte Budgets, konkrete Anwendungsfälle und Entscheidungsmandate mitbringen. Damit packen wir aus meiner Sicht das Kernproblem Europas an: Wir verschaffen Zugang zu ersten Kunden und realen Anwendungen.

StartingUp: Durch langsames Wachstum entsteht ein Druck auf Gründer*innen, in die USA auszuweichen. Dort lockt der Markt gezielt mit Milliarden-Subventionen und schnellem Kapital. Was entgegnest du einem DeepTech-Gründer, der heute zu dir sagt: „Herr Schilling, Europa ist nett für die Forschung, aber um ein Einhorn zu bauen, muss ich sofort in die USA?“

Martin Schilling: Ich würde niemandem pauschal davon abraten, in die USA zu gehen. Für viele Modelle ist das absolut sinnvoll, gerade wenn es um Kapital und Marktskalierung geht. Aber ich würde zwei Dinge entgegnen. Erstens: Europa ist kein schlechter Ort, um ein DeepTech-Unternehmen zu bauen. Wir haben exzellente Forschung, starke Industriepartner und zunehmend auch Kapital. Zweitens – und wichtiger: Der Engpass ist oft nicht der Standort, sondern die Geschwindigkeit, mit der man Kommerzialisierung erreicht. Wenn ein Start-up es schafft, früh echte Kunden zu gewinnen, Piloten zu fahren und Umsatz aufzubauen, dann wird Kapital folgen, auch in Europa. Mit Deep Tech Momentum möchten wir den Weg von Technologie zur Anwendung beschleunigen. Denn es geht nicht um Europa vs. USA. Es geht darum, ob ein Unternehmen es schafft, aus Technologie ein funktionierendes Geschäft zu machen.

Danke, Martin Schilling, für die spannenden Insights

Das Interview führte StartingUp-Chefredakteur Hans Luthardt

Versandlogistik für E-Commerce-Gründer

Erfahren Sie, worauf Gründer im E-Commerce in Bezug auf die Versandlogistik achten sollten.

Viele E-Commerce-Gründer investieren vor dem Shop-Launch viel Zeit in Produktentwicklung, Shopdesign und Marketing. Die Versandlogistik wird dagegen oft unterschätzt – obwohl sie bereits in den ersten Monaten direkten Einfluss auf Kosten, Kundenbewertungen und Retourenquoten hat.

Gerade Verpackungen entwickeln sich schnell zum versteckten Kostenfaktor. Zu große Kartons erhöhen die Versandkosten, schlechte Polsterung führt zu Reklamationen und unnötig aufwendige Verpackungen wirken weder nachhaltig noch professionell. Wer früh sinnvolle Standards definiert, spart langfristig Zeit und Geld. Die folgenden Abschnitte enthalten hierzu einige Tipps.

Die richtige Kartongröße spart mehr Geld als viele denken

Viele Gründer starten mit wenigen Standardkartons „von der Stange“. Das funktioniert am Anfang zwar pragmatisch, wird aber schnell teuer.

Versanddienstleister wie DHL kalkulieren Preise nicht nur nach Gewicht, sondern auch nach Paketmaßen. Bereits leicht überdimensionierte Sendungen können in höhere Versandklassen fallen. Besonders problematisch wird das, wenn kleine Produkte in viel zu großen Kartons verschickt werden.

Ein typisches Beispiel: Ein Produkt mit 120 × 80 × 40 mm landet in einem Karton mit 400 × 300 × 200 mm. Dadurch steigen nicht nur die Versandkosten, sondern auch der Bedarf an Füllmaterial.

Für viele kleinere Artikel reichen Größen wie 200 × 150 × 90 mm oder 250 × 200 × 120 mm völlig aus. Wer Versandkartons in passender Größe auswählt und früh mit standardisierten Größen arbeitet, kann Lager- und Versandkosten deutlich besser kontrollieren. In der Praxis ist es sinnvoll, zu Beginn mit drei bis fünf Standardgrößen zu arbeiten. Das vereinfacht Lagerung, Einkauf und Verpackungsprozesse deutlich.

Wichtig ist außerdem, die Entwicklung des eigenen Sortiments im Blick zu behalten. Viele Shops erweitern ihr Portfolio bereits nach wenigen Monaten. Dann sollte auch das Verpackungssystem angepasst werden.

Einwellig oder doppelwellig? Warum die Kartonqualität wichtig ist

Viele Gründer achten beim Kartoneinkauf zuerst auf den Preis. Dabei spielt die Stabilität eine entscheidende Rolle.

Im E-Commerce kommen vor allem einwellige und doppelwellige Kartons zum Einsatz. Einwellige Varianten wie 1.30B eignen sich für leichte Produkte wie Kleidung, Kosmetik oder kleinere Accessoires. Sie sind günstiger und platzsparender.

Doppelwellige Kartons wie 2.30BC bieten dagegen deutlich mehr Stabilität. Sie eignen sich für empfindliche oder schwerere Produkte sowie längere Transportwege. Wer Technik, zum Beispiel Smarthome Lösungen, wie sie unter anderem auf den Seiten von homeandsmart immer wieder vorgestellt werden, Glaswaren oder schwere Einzelprodukte verschickt, sollte eher auf doppelwellige Lösungen setzen.

Ganz wichtig: Polstermaterial richtig einsetzen

Auch beim Füllmaterial machen viele Einsteiger typische Fehler.

Zu wenig Polsterung führt schnell zu beschädigten Produkten. Zu viel Verpackungsmaterial wirkt dagegen unprofessionell und erhöht die Kosten unnötig. Kunden reagieren inzwischen zudem sensibel auf übertriebene Plastikverpackungen und wissen es zu schätzen, wenn ein Start-up zum Beispiel nachhaltig ist.

In der Praxis gilt deshalb: so kompakt wie möglich, aber so sicher wie nötig.

Papierpolster oder Recyclingmaterial wirken heute meist hochwertiger als große Mengen Kunststofffüllung. Wichtig ist außerdem, dass Produkte im Karton möglichst wenig Spielraum haben. Bereits einfache Falltests helfen dabei, die Verpackung realistisch zu prüfen.

Gerade bei zerbrechlichen Produkten lohnt es sich, mehrere Verpackungsvarianten zu testen, bevor größere Mengen bestellt werden.

Bestellmengen realistisch planen: So geht’s!

Viele Gründer bestellen ihre ersten Kartons entweder viel zu knapp oder direkt palettenweise.

Beides kann problematisch werden. Kleine Mengen verursachen oft hohe Stückpreise und ständigen Nachbestellaufwand. Zu große Bestellungen blockieren dagegen Lagerfläche und binden Kapital.

Gerade in den ersten zwölf Monaten verändern sich Sortiment und Versandzahlen häufig schneller als erwartet. Deshalb solltest Du zunächst eher konservativ planen. Für viele kleine Shops sind Verpackungsbestände für zwei bis drei Monate ein sinnvoller Richtwert.

Wichtig ist außerdem die Lagerkapazität. Kartons benötigen deutlich mehr Platz als viele Gründer anfangs kalkulieren.

Verpackungsgesetz und LUCID nicht vergessen!

Ein häufiger Fehler vieler E-Commerce-Einsteiger betrifft die gesetzlichen Pflichten rund um Verpackungen.

Sobald Du Verpackungen gewerblich in Umlauf bringst, greift in Deutschland das Verpackungsgesetz. Das betrifft praktisch jeden Online-Shop.

Du musst Dich deshalb bei der Zentralen Stelle Verpackungsregister registrieren und eine sogenannte LUCID-Nummer beantragen. Zusätzlich ist eine Beteiligung an einem dualen System erforderlich.

Wer diese Pflichten ignoriert, riskiert Abmahnungen und Bußgelder. Viele Gründer kümmern sich erst darum, wenn der Shop bereits läuft. Sinnvoller ist es, das Thema direkt vor dem Verkaufsstart sauber aufzusetzen.

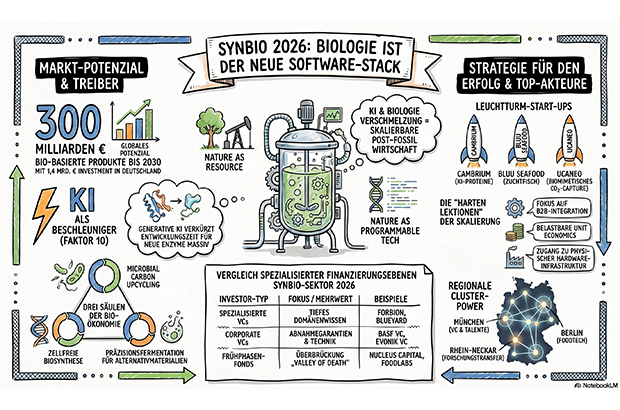

SynBio-Start-up-Report 2026

Biologie ist der neue Code: Wie Synthetische Biologie (SynBio) die Industrie neu programmiert und welche Start-ups dabei hierzulande federführend sind.

Die Vision einer post-fossilen Wirtschaft ist im Jahr 2026 keine bloße Utopie mehr, sondern eine präzise Ingenieursleistung. Wir erleben den Moment, in dem die Natur von einer Ressource, die wir ausbeuten, zu einer Technologie wird, die wir programmieren. In den Laboren der Republik entstehen heute Lösungen für die größten Versorgungskrisen unserer Zeit. Der Aufstieg der Synthetischen Biologie (SynBio) markiert den Übergang vom Zeitalter der Petrochemie in das Zeitalter der Biomanufaktur – eine Transformation, die so tiefgreifend ist wie die industrielle Revolution, jedoch mit der Geschwindigkeit der digitalen Transformation erfolgt.

Wenn Bits auf Atome treffen

Der SynBio-Markt ist 2026 in eine Phase der industriellen Skalierung eingetreten. Aktuelle Analysen der KfW sowie Branchenberichte von BCG beziffern das globale Marktpotenzial für bio-basierte Produkte bis Ende des Jahrzehnts auf über 300 Milliarden Euro. Allein in Deutschland ist das Investitionsvolumen in DeepTech-BioTech-Start-ups im vergangenen Geschäftsjahr laut Bitkom-Daten auf einen Rekordwert von 1,4 Milliarden Euro gestiegen. Der entscheidende technologische Katalysator ist die Verschmelzung von Generativer KI und Biologie. Dank Modellen, die Proteinfaltungen präziser vorhersagen können, als es je ein menschlicher Forscher vermochte, wurde die Entwicklungszeit für neue Enzyme um den Faktor zehn verkürzt. Die Biologie wird damit endgültig zum „Software-Stack“, bei dem Design-Build-Test-Learn-Zyklen in digitalisierten Bio-Gießereien automatisiert ablaufen.

Jenseits der Petrischale: Die Treiber der Bio-Ökonomie

Drei spezifische Sub-Sektoren dominieren in diesem Jahr die Agenda der Investor*innen. An erster Stelle steht die zellfreie Biosynthese, bei der komplexe Moleküle ohne den Einsatz lebender Zellen produziert werden, was die Skalierbarkeit massiv erhöht. Pioniere wie das US-Unternehmen Solugen haben hier den Weg geebnet, doch deutsche Akteure ziehen in der Effizienz der Bioreaktor-Steuerung nach. Ein zweiter massiver Treiber ist das Microbial Carbon Upcycling: Mikroben werden so programmiert, dass sie industrielles CO2 direkt in hochwertige Proteine oder Kunststoffe umwandeln. Hier verschmelzen Klimaschutz und Produktion zu einer Einheit. Drittens sehen wir den Siegeszug der Biomanufaktur bei Alternativmaterialien – sei es durch Biomasse-Fermentation für Lederersatz aus Myzel oder durch echte Präzisionsfermentation, bei der etablierte Akteure wie die bayrische AMSilk zeigen, dass programmierte Spinnenseide-Proteine bereits in Serie gehen können. Die Lieferkette der Mode- und Automobilindustrie wird durch diese Biopolymere radikal dekarbonisiert.

Die harten Lektionen der Skalierung

Der Weg zum Erfolg war jedoch von schmerzhaften Rückschlägen gepflastert. Der prominente Crash des einstigen Branchenlieblings Amyris im Jahr 2023 wirkt bis heute als warnendes Beispiel nach. Das Unternehmen scheiterte trotz Milliardenbewertung an der Komplexität der vertikalen Integration und dem Versuch, gleichzeitig Technologieplattform und B2C-Marke zu sein. Für heutige Gründer*innen haben sich daraus vier fatale Fallstricke herauskristallisiert, die über Sieg oder Niederlage entscheiden. Erstens: Die Ignoranz gegenüber den Unit Economics. Ein Produkt, das im 5-Liter-Maßstab funktioniert, muss im 50.000-Liter-Kessel nicht zwangsläufig profitabel sein. Zweitens: Das „Regulatorik-Vakuum“. Wer die EU-Novel-Food-Verordnungen oder GVO-Richtlinien nicht von Tag eins an in die Produktentwicklung einplant, riskiert Jahre des Stillstands. Drittens: Die Fokussierung auf den Endkonsument*innen statt auf B2B-Integration. Der wahre Hebel liegt in der Lizenzierung von Prozessen an die Industrie. Viertens: Die Unterschätzung der Hardware-Komponente. SynBio ist kein reines Software-Business; ohne Zugang zu physischer Infrastruktur bleibt jede Innovation im Labor gefangen.

Deutschlands Bio-Cluster

Deutschland hat sich im internationalen Vergleich als einer der stärksten Hubs für SynBio etabliert, getrieben durch eine einzigartige Verzahnung von Spitzenforschung und industrieller Basis. In München und dem angeschlossenen IZB Martinsried konzentriert sich die größte Dichte an Venture Capital und Talenten, eng flankiert durch die Exzellenz-Cluster der TU München. Berlin hat sich durch spezialisierte Inkubatoren wie den ProVeg Incubator, Atlantic Food Labs (FoodLabs) und den Science Park Berlin-Buch zum absoluten Zentrum für FoodTech und zelluläre Landwirtschaft entwickelt. Ein weiterer Hotspot ist das Rhein-Neckar-Delta rund um Heidelberg, wo das European Molecular Biology Laboratory (EMBL) und der BioRN-Cluster eine Brücke zwischen Grundlagenforschung und Marktreife schlagen. Aachen punktet mit der RWTH und einer starken Fokussierung auf Bio-Verfahrenstechnik, während der Raum Darmstadt/Frankfurt durch die Nähe zu Giganten wie Merck und die TU Darmstadt als Kraftzentrum für die industrielle Bioproduktion gilt.

Investor*innen-Radar

Die Finanzierungslandschaft hat sich spezialisiert. Wir unterscheiden im Jahr 2026 vier Ebenen der Kapitalgeber*innen. Die spezialisierten VCs wie Forbion, BlueYard Capital oder Sofinnova Partners bringen das notwendige tiefe Domänenwissen mit. Auf der zweiten Ebene stehen Top-Tier Generalisten wie HV Capital und Earlybird, die SynBio zunehmend als Teil ihrer Dekarbonisierungs-Strategie begreifen. Besonders kritisch für die Skalierung sind die Corporate VCs der Industrie, allen voran BASF Venture Capital und Evonik Venture Capital, die nicht nur Geld, sondern auch Abnahmegarantien und technisches Know-how bieten. In der Frühphase bewegen zudem spezialisierte Mikro-Fonds wie Nucleus Capital oder erfahrene ClimateTech-Angels den Markt, oft organisiert in Syndikaten, die das „Valley of Death“ zwischen Labor und Prototyp überbrücken

Die Top-Start-ups: Unsere Must-Watch-Liste 2026

Für die folgende Auswahl der Start-ups haben wir Unternehmen analysiert, die nach 2019 in Deutschland gegründet wurden. Die Auswahlkriterien basieren auf der technologischen Tiefe (IP-Portfolio), dem Reifegrad der Pilotierung, der Validierung durch renommierte Investoren sowie dem Potenzial, bestehende industrielle Lieferketten systemisch zu verändern. Diversität in Gründungsteams und die Skalierbarkeit der zugrunde liegenden Bio-Plattform waren weitere entscheidende Faktoren.

- Cambrium (Berlin, gegründet 2020): Das Team um Dr. Mitchell Duffy nutzt eine KI-gestützte Designplattform, um neuartige Proteine mit molekularen Funktionen zu entwickeln, die in der Natur so nicht vorkommen. Ihr Fokus liegt auf der Kosmetik- und Textilindustrie, wo sie petrochemische Inhaltsstoffe durch bio-designte Alternativen ersetzen. Mit massiven Finanzierungsrunden, angeführt von Tech-Schwergewichten wie Essential Capital und dem Google-KI-Fonds Gradient Ventures, gilt Cambrium als Leuchtturm für eine neue Generation von Biomaterial-Zulieferern, die aus digitalem Code physische Hochleistungsprodukte erschaffen.

- Bluu Seafood (Berlin, gegründet 2020): Gegründet von Dr. Sebastian Rakers und Simon Fabich, ist Bluu einer der führenden europäischen Akteure im Bereich kultivierter Fisch. Durch die Kultivierung echter Fischzellen im Bioreaktor adressieren sie die Überfischung der Meere. Nach signifikanten Investments durch Lead-Investor Sparkfood sowie LBBW VC und Delivery Hero Ventures steht das Unternehmen kurz vor der ersten Marktzulassung in Singapur und den USA.

- Colipi (Hamburg, gegründet 2022): Das Spin-off der TU Hamburg, geführt von Maximilian Webers, nutzt eine patentierte Gasfermentationstechnologie, um CO2 in nachhaltige Öle und Lipide umzuwandeln. Der USP von Colipi ist die Nutzung von industriellen Abgasströmen als Rohstoff, was die Produktion extrem kosteneffizient macht. Sie konnten sich frühzeitig die Unterstützung von Top-Investoren wie dem High-Tech Gründerfonds (HTGF) und dem Innovationsstarter Fonds Hamburg sichern.

- Kynda (Jelmstorf, gegründet 2019): Ursprünglich als Keen 4 Greens von Daniel MacGowan-von Holstein und Franziskus Schnabel gegründet, bietet Kynda Plug-and-Play-Fermentationssysteme für die Lebensmittelindustrie an. Als B2B-Technologiepartner stellen sie modulare Bioreaktoren und Pilzkulturen bereit, mit denen Hersteller ihre eigenen Produktionsabfälle direkt vor Ort kostengünstig in Mykoproteine umwandeln können. Eine kürzliche 3-Millionen-Euro-Seed-Finanzierung – angeführt vom VC EnjoyVenture und massiv flankiert durch ein strategisches Investment des Geflügel-Giganten PHW-Gruppe – unterstreicht das enorme Skalierungspotenzial dieses Kreislauf-Modells.

- Nosh.bio (Berlin, gegründet 2022): Das Team um Tim Fronzek nutzt Pilzbiomasse als funktionalen Inhaltsstoff für die Lebensmittelindustrie, um Clean-Label-Produkte ohne Zusatzstoffe zu ermöglichen. Der technologische Vorsprung von Nosh.bio liegt in der Geschwindigkeit des Fermentationsprozesses. Frühphasen-Finanzierungen durch Earlybird unterstreichen das hohe Vertrauen in das Skalierungspotenzial.

- Ucaneo (Berlin, gegründet 2022): Das Team um Florian Tiller und Carla Glassl beweist, dass Synthetische Biologie auch beim Direct Air Capture (DAC) den Unterschied macht. Statt energieintensiver chemischer Filter nutzt Ucaneo eine biomimetische Technologie: Sie setzen das Enzym Carboanhydrase ein – eines der schnellsten Enzyme der Natur –, um CO2 bei Raumtemperatur direkt aus der Umgebungsluft zu binden. Mit starken Frühphasen-Finanzierungen durch DeepTech-Fonds wie Nucleus Capital und der US-amerikanischen Grantham Foundation baut Ucaneo derzeit in Berlin-Marienfelde ihre erste industrielle Testanlage auf.

- Insempra (München, gegründet 2021): Das Team um Gründer Jens Klein hat sich zum Ziel gesetzt, die massive Abhängigkeit der globalen Lieferketten von der Petrochemie zu beenden. Über ihre B2B-Technologieplattform nutzen sie Präzisionsfermentation, um maßgeschneiderte Inhaltsstoffe für die Kosmetik-, Lebensmittel- und Textilbranche quasi zu programmieren – von bio-basierten Lipiden und Aromen bis hin zu neuartigen Proteinfasern. Eine hochkarätige Finanzierungsrunde, angeführt von europäischen DeepTech-Schwergewichten wie EQT Ventures und BlueYard Capital, unterstreicht den Anspruch von Insempra, ein globaler industrieller Zulieferer der nächsten Generation zu werden.

Ausblick & Fazit: Der globale Wettlauf

Der Blick über den Tellerrand zeigt: Wir stehen in einem globalen Systemwettbewerb. In den USA treibt die per Executive Order erlassene „National Biotechnology and Biomanufacturing Initiative“ Milliardeninvestitionen in die heimische Infrastruktur, flankiert von Pionieren, die dort und in Frankreich (wie Biomemory) bereits an der Verschmelzung von SynBio und DNA-Datenspeicherung arbeiten. In Asien, insbesondere in China und Singapur, werden derweil regulatorische Hürden in Rekordzeit abgebaut, um die Marktführerschaft bei der Biomanufaktur zu übernehmen. Flankiert wird dies von Hubs wie Israel, die mit massivem VC-Kapital den globalen Markt für kultivierte Proteine dominieren wollen.

Das Fazit für das Jahr 2026: Biologie ist die Infrastruktur der Zukunft. Für Gründer*innen bedeutet dies, dass die Zeit der reinen Plattform-Versprechen vorbei ist; gefragt sind konkrete Produkte und belastbare Unit Economics. Für Investor*innen bietet SynBio die seltene Chance, echte „Impact-Rendite“ zu erzielen, indem sie Industrien transformieren, die über Jahrzehnte festgefahren waren. Wer heute den Code der Natur versteht und skalieren kann, wird die Welt von morgen nicht nur verstehen, sondern neu bauen.

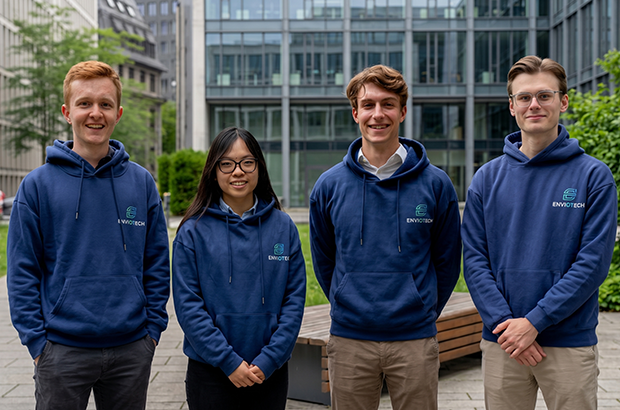

ENVIOTECH sichert sich Millionenfinanzierung für intelligente öffentliche Straßenbeleuchtung

Das Frankfurter Start-up ENVIOTECH rund um Adrian Rhaese, Linh Pham, Dustin Arnold und Peter Kletsko hat eine Pre-Seed-Runde in Höhe von einer Million Euro abgeschlossen, um öffentliche Straßenbeleuchtung intelligent nachzurüsten. Doch der Markt für kommunale Infrastruktur ist hart umkämpft und bürokratisch. Kann das junge Team die öffentlichen Verwaltungen überzeugen?

Es ist ein klassisches Gründer*innen-Narrativ: Aus einem persönlichen Schmerzpunkt entsteht eine Geschäftsidee. Im Fall von ENVIOTECH war es ein Fahrradunfall. Der beste Freund von Mitgründer Adrian Rhaese verunglückte, weil in einer deutschen Stadt die Straßenlaternen aufgrund gestiegener Stromkosten abgeschaltet worden waren. Dieser Vorfall weckte bei Rhaese das Unverständnis darüber, dass in einem wirtschaftlich starken Land ausgerechnet an der Sicherheit gespart wird – und legte den Grundstein für das Smart-City-Start-up.

Bye-bye Bankenturm: Der Sprung ins kalte Wasser

Anstatt ihren als sicher geltenden Karriereweg fortzusetzen, verließen Adrian Rhaese und Mitgründerin Linh Pham ihre Positionen als duale Studierende bei der Deutschen Bank. Sie entschieden sich bewusst für das unternehmerische Risiko, um reale Infrastrukturprobleme zu lösen.

Eine erste Bestätigung für diesen Schritt erhielt das junge Team durch die Aufnahme in das EWOR Fellowship. Daniel Dippold, Gründer und CEO von EWOR, bescheinigt dem Team den richtigen Fokus: „Unspektakuläre Infrastruktur gewinnt langfristig fast immer. Straßenbeleuchtung ist nicht glamourös, aber sie ist allgegenwärtig, unverzichtbar und aus keiner Stadt wegzudenken.“

Plug-and-Play am Lichtmast: Das 15-Minuten-Update

Die technische Lösung von ENVIOTECH setzt auf Pragmatismus: Anstatt Laternen kostenintensiv komplett auszutauschen, bietet das Unternehmen ein Retrofit-System an. Das Produkt soll sich laut Unternehmensangaben in unter 15 Minuten in bestehende Leuchten integrieren lassen.

Die nachgerüsteten Laternen kommunizieren als Mesh-Netzwerk miteinander und dimmen das Licht KI-gesteuert und bedarfsgerecht anhand von Bewegungserkennung. Das Startup verspricht dadurch Energieeinsparungen von bis zu 80 Prozent; gleichzeitig soll die öffentliche Sicherheit erhöht werden. Kommunen erhalten so die Möglichkeit, ihre Beleuchtung zentral zu steuern und in Echtzeit zu überwachen.

Um das Konzept in die Fläche zu tragen, konnte ENVIOTECH nun eine Pre-Seed-Finanzierung in Höhe von 1 Million Euro einsammeln. Angeführt wird die Runde passenderweise vom ehemaligen Co-CEO der Deutschen Bank, Jürgen Fitschen. Ergänzt wird das Konsortium durch Ex-MAN-CEO Joachim Drees, Alexander Eyhorn (Gründer von Bidirex) und Danilo Jovicic-Albrecht (Mitgründer des auf Kommunen spezialisierten Startups Vialytics). Mit dem frischen Kapital sollen Pilotprojekte forciert und das Technologieportfolio weiterentwickelt werden.

Der Endgegner heißt B2G-Markt: David gegen die Industrie-Goliaths

So einleuchtend die Technologie klingt, das Geschäftsmodell von ENVIOTECH steht vor gewaltigen Hürden. Der B2G-Markt (Business-to-Government) ist für Start-ups extrem schwierig. Kommunen, die ENVIOTECHs primäre Zielgruppe darstellen, arbeiten mit langen Budgetzyklen und streng regulierten öffentlichen Ausschreibungsverfahren. Bis ein Pilotprojekt zu einem flächendeckenden Rollout führt, vergehen oft Jahre.

Darüber hinaus agiert das Start-up nicht im luftleeren Raum. Der Smart-Lighting-Markt wird von Industriegiganten wie Signify oder Schréder dominiert, die längst eigene IoT-Lichtsteuerungssysteme anbieten. Auch andere Start-ups wie Tvilight oder Icegateway haben das Potenzial vernetzter Straßenbeleuchtung erkannt.

Der entscheidende USP von ENVIOTECH muss daher in der Geschwindigkeit und Einfachheit liegen: Gelingt die versprochene rasante Installation und können Kommunen die Lösung ohne massive Tiefbauarbeiten testen, hat das Start-up einen echten Wettbewerbsvorteil. Besonders klug ist hierbei die Auswahl der Investor*innen: Mit Drees und Jovicic-Albrecht hat das Gründerduo Köpfe an Bord geholt, die wissen, wie man komplexe Produkte an die öffentliche Hand verkauft. Schafft es ENVIOTECH, den extrem zähen Vertriebszyklus öffentlicher Verwaltungen zu knacken, könnte das Unternehmen zu einem hochrentablen Hidden Champion heranwachsen.

Württemberger Medien: Nachhaltige Wachstumsstrategien

Wie die Württemberger Medien Marketing Agentur Unternehmen mit datengetriebenen Strategien und klarer Positionierung unterstützt.

Digitale Sichtbarkeit ist heute für Unternehmen kein optionaler Erfolgsfaktor mehr, sondern eine Grundvoraussetzung. Märkte werden transparenter, Wettbewerber sichtbarer und Kunden anspruchsvoller. Wer sich behaupten will, muss nicht nur präsent sein, sondern gezielt kommunizieren, analysieren und optimieren. Genau an dieser Schnittstelle zwischen Strategie, Technologie und Kommunikation setzt die wtv Online Marketing Agentur an.

Das Unternehmen hat sich darauf spezialisiert, digitale Potenziale strukturiert zu erschließen und für seine Kunden messbar zu machen. Dabei geht es nicht um kurzfristige Maßnahmen oder einzelne Kampagnen, sondern um nachhaltige Strategien, die Wachstum langfristig unterstützen.

Von der Idee zur klaren digitalen Strategie

Viele Unternehmen starten mit einzelnen Marketingmaßnahmen, ohne eine übergeordnete Strategie zu verfolgen. Social-Media-Kanäle werden aufgebaut, Anzeigen geschaltet oder Inhalte produziert – oft ohne klare Zielsetzung oder langfristige Planung. Das Ergebnis: hohe Aufwände bei begrenzter Wirkung.

Die Württemberger Medien Agentur verfolgt bewusst einen anderen Ansatz. Im Mittelpunkt steht zunächst die Analyse. Bevor Maßnahmen umgesetzt werden, geht es darum, das Unternehmen, die Zielgruppe und den Markt genau zu verstehen.

Dazu gehören unter anderem:

- die Definition klarer Ziele und Zielgruppen

- die Analyse bestehender Marketingaktivitäten

- die Bewertung von Wettbewerbern und Marktposition

- die Identifikation von Potenzialen und Schwachstellen

Auf dieser Grundlage entsteht eine individuelle Strategie, die nicht nur kurzfristige Erfolge ermöglicht, sondern langfristig trägt.

Datenbasierte Entscheidungen statt Bauchgefühl

Ein wesentlicher Unterschied moderner Online-Marketing-Ansätze liegt in der Nutzung von Daten. Während Marketing früher oft stark von Erfahrung und Intuition geprägt war, stehen heute umfangreiche Analysemöglichkeiten zur Verfügung.

Die Württemberger Medien Agentur nutzt diese Möglichkeiten gezielt, um fundierte Entscheidungen zu treffen. Daten werden nicht nur gesammelt, sondern interpretiert und in konkrete Maßnahmen übersetzt. Dadurch lassen sich Maßnahmen kontinuierlich optimieren und Budgets effizient einsetzen.

Diese Arbeitsweise bringt mehrere Vorteile mit sich:

- bessere Planbarkeit von Marketingmaßnahmen

- transparente Erfolgsmessung

- gezielte Optimierung einzelner Kanäle

- langfristige Skalierbarkeit von Strategien

Gerade für wachsende Unternehmen ist diese Transparenz ein entscheidender Faktor.

Ganzheitlicher Blick auf digitale Kanäle

Online-Marketing besteht heute aus einer Vielzahl unterschiedlicher Disziplinen. Suchmaschinenoptimierung, Performance Marketing, Content-Strategie und Social Media greifen ineinander und beeinflussen sich gegenseitig.

Die Württemberger Medien Agentur betrachtet diese Bereiche nicht isoliert, sondern als Teil eines Gesamtsystems. Ziel ist es, die einzelnen Kanäle sinnvoll miteinander zu verknüpfen und so eine konsistente Markenkommunikation zu schaffen.

Dabei werden unter anderem folgende Bereiche integriert:

- Suchmaschinenoptimierung (SEO) für nachhaltige Sichtbarkeit

- Webdesign und Website-Entwicklung für einen professionellen digitalen Auftritt

- Digitale Mitarbeitergewinnung über zielgerichtete Online-Kampagnen

- Ganzheitliche strategische Beratung zur digitalen Sichtbarkeit und Kundengewinnung

Durch diese Verzahnung entsteht ein Marketingansatz, der sowohl kurzfristige Ergebnisse als auch langfristige Wirkung ermöglicht.

Fokus auf messbare Ergebnisse

Ein zentraler Anspruch der Württemberger Medien ist die Messbarkeit von Erfolg. Marketing wird nicht als kreativer Selbstzweck verstanden, sondern als strategisches Instrument zur Erreichung konkreter Unternehmensziele.

Das bedeutet, dass jede Maßnahme klar definierten Kennzahlen zugeordnet wird. Ob Traffic, Conversion-Rate oder Umsatz – die Ergebnisse werden kontinuierlich überprüft und ausgewertet.

Diese Transparenz schafft Vertrauen und ermöglicht es Kunden, ihre Investitionen nachvollziehbar zu steuern. Gleichzeitig bildet sie die Grundlage für eine kontinuierliche Weiterentwicklung der Strategie.

Zusammenarbeit auf Augenhöhe

Neben fachlicher Expertise spielt auch die Zusammenarbeit eine entscheidende Rolle. Die Württemberger Medien Agentur versteht sich nicht als externer Dienstleister im klassischen Sinne, sondern als strategischer Partner.

Das zeigt sich vor allem in der Kommunikation. Projekte werden eng mit den Kunden abgestimmt, Entscheidungen transparent getroffen und Entwicklungen regelmäßig besprochen. Ziel ist es, gemeinsam Lösungen zu entwickeln, die zum jeweiligen Unternehmen passen.

Diese partnerschaftliche Herangehensweise bringt mehrere Vorteile:

- klare Abstimmung von Zielen und Erwartungen

- schnelle Anpassung an Veränderungen

- langfristige Zusammenarbeit statt kurzfristiger Projekte

- bessere Integration in bestehende Unternehmensstrukturen

Gerade in dynamischen Märkten ist diese Flexibilität ein wichtiger Erfolgsfaktor.

Anpassungsfähigkeit in einem dynamischen Umfeld

Die digitale Welt verändert sich kontinuierlich. Neue Plattformen entstehen, Algorithmen werden angepasst und Nutzerverhalten entwickelt sich weiter. Für Unternehmen bedeutet das, dass Strategien regelmäßig überprüft und angepasst werden müssen.

Die Württemberger Medien Agentur begegnet dieser Dynamik mit einem flexiblen Ansatz. Statt starrer Konzepte setzt sie auf kontinuierliche Optimierung und Anpassung. Entwicklungen werden frühzeitig erkannt und in die Strategie integriert.

Dadurch bleiben Kunden nicht nur wettbewerbsfähig, sondern können neue Chancen aktiv nutzen.

Branchenübergreifende Erfahrung

Ein weiterer Vorteil der Württemberger Medien Online Marketing Agentur liegt in ihrer branchenübergreifenden Erfahrung. Zu den Kunden des Unternehmens zählen lokale und regionale Dienstleister, Handwerks- und Gewerbebetriebe sowie Unternehmen aus dem Mittelstand. Dadurch entsteht ein breites Verständnis für verschiedene Geschäftsmodelle, Zielgruppen und Marktmechaniken.

Diese Vielfalt hilft dabei, funktionierende Strategien nicht isoliert zu betrachten, sondern sinnvoll auf andere Bereiche zu übertragen. Was bei einem Dienstleistungsunternehmen zu mehr Sichtbarkeit und Anfragen führt, kann, richtig angepasst, auch für Handwerks- und Gewerbebetriebe sehr gut funktionieren. Gleichzeitig entstehen durch diese Perspektivwechsel oft innovative Ansätze, die über klassische Lösungen hinausgehen.

Dennoch bleibt jede Strategie individuell. Die Württemberger Medien Agentur setzt nicht auf standardisierte Konzepte, sondern passt Maßnahmen präzise an die jeweiligen Anforderungen an. Marktumfeld, Wettbewerbssituation und Zielgruppe werden dabei ebenso berücksichtigt wie interne Strukturen und Ressourcen des Kunden.

So entsteht ein ausgewogenes Verhältnis zwischen Erfahrung und Individualität – eine Kombination, die es ermöglicht, sowohl effizient als auch kreativ zu arbeiten und nachhaltige Ergebnisse zu erzielen.

Nachhaltiges Wachstum statt kurzfristiger Erfolge

Im Zentrum der Arbeit steht ein klares Ziel: nachhaltiges Wachstum. Während viele Marketingmaßnahmen auf schnelle Ergebnisse ausgerichtet sind, verfolgt die Württemberger Medien Agentur einen langfristigen Ansatz. Es geht nicht darum, kurzfristig Aufmerksamkeit zu erzeugen, sondern darum, stabile Strukturen aufzubauen, die dauerhaft funktionieren.

Das bedeutet, dass nicht nur einzelne Kampagnen optimiert werden, sondern das gesamte digitale Fundament eines Unternehmens gestärkt wird. Sichtbarkeit in Suchmaschinen, eine klare Markenpositionierung und eine gezielte Kundenansprache werden Schritt für Schritt aufgebaut und kontinuierlich weiterentwickelt.

Dabei spielen mehrere Faktoren zusammen. Eine technisch optimierte Website sorgt für eine bessere Auffindbarkeit, ein professioneller Markenauftritt stärkt die Außenwirkung und datenbasierte Kampagnen bringen gezielt Reichweite. Durch diese Kombination entsteht ein System, das nicht von einzelnen Maßnahmen abhängig ist, sondern als Ganzes wirkt.

Ein weiterer Vorteil dieses Ansatzes liegt in der Planbarkeit. Unternehmen erhalten eine klare Perspektive, wie sich ihre Marketingaktivitäten entwickeln und welche Ergebnisse realistisch zu erwarten sind. Gleichzeitig bleibt genügend Flexibilität, um auf Veränderungen im Markt zu reagieren und neue Chancen zu nutzen.

Dieser Fokus auf langfristige Entwicklung sorgt dafür, dass Unternehmen nicht nur kurzfristig wachsen, sondern sich nachhaltig im Wettbewerb positionieren können.

Fazit

Die Anforderungen an modernes Online-Marketing sind heute komplexer denn je. Unternehmen müssen sich in einem dynamischen Umfeld behaupten, ihre Zielgruppen verstehen und gleichzeitig effizient arbeiten. Gleichzeitig steigt der Druck, Marketingmaßnahmen nicht nur umzusetzen, sondern auch deren Wirkung nachvollziehbar zu machen.

Die Württemberger Medien Marketing Agentur zeigt, wie sich diese Herausforderungen strukturiert und zielgerichtet angehen lassen. Durch die Kombination aus datenbasierter Analyse, strategischer Planung und kontinuierlicher Optimierung entstehen Lösungen, die messbare Ergebnisse liefern und gleichzeitig langfristig tragen.

Besonders hervorzuheben ist der ganzheitliche Ansatz. Statt isolierter Maßnahmen entwickelt die Agentur ein umfassendes System, in dem alle digitalen Kanäle sinnvoll miteinander verknüpft sind. Dadurch wird nicht nur kurzfristige Sichtbarkeit erzeugt, sondern eine stabile Grundlage für nachhaltiges Wachstum geschaffen.

Für Unternehmen, die ihre digitale Präsenz gezielt ausbauen und langfristig stärken möchten, bietet dieser Ansatz eine klare Orientierung. Er verbindet Strategie, Technologie und Kommunikation zu einem durchdachten Gesamtbild – und schafft damit die Voraussetzungen für kontinuierlichen Erfolg in einem sich ständig verändernden Marktumfeld.

Wie das TechBio-Start-up mbiomics mit 30 Mio. Euro die Krebstherapie skalierbar machen will

Stuhltransplantationen haben gezeigt, dass das Darmmikrobiom ein mächtiger Hebel gegen Krebs sein kann – doch der Ansatz ist bisher kaum standardisierbar. Das Münchner Unternehmen mbiomics setzt auf künstliche Intelligenz und maßgeschneiderte Bakterien-Cocktails aus dem Labor. Mit dem Abschluss einer 30-Millionen-Euro-Serie-A-Runde rückt die klinische Phase näher. Ein genauer Blick auf das Geschäftsmodell, die Gründer*innen und einen hart umkämpften globalen Markt.

Wer heute von modernster Krebstherapie spricht, kommt am menschlichen Darm nicht mehr vorbei. Die wissenschaftliche Datenlage der letzten Jahre hat sich massiv verdichtet: Ob ein Patient auf revolutionäre Krebs-Immuntherapien (wie Immun-Checkpoint-Inhibitoren) anspricht, hängt maßgeblich von der individuellen Zusammensetzung seines Mikrobioms ab. Das Münchner TechBio-Unternehmen mbiomics hat sich genau dieses Zusammenspiel zur Mission gemacht und gab heute den dritten Abschluss seiner Serie-A-Finanzierungsrunde bekannt. Mit neu eingeworbenen 12 Millionen Euro wächst das Gesamtvolumen der Runde auf beachtliche 30 Millionen Euro.

Das Kapital, das unter anderem von erfahrenen Investoren wie den MIG Fonds und Bayern Kapital stammt, markiert für das 2020 gegründete Unternehmen einen entscheidenden Wendepunkt: den Übergang von der reinen Technologieplattform hin zur klinischen Anwendung am Menschen. Der führende Wirkstoffkandidat „MBX-116“ soll 2027 in einer Phase-1B-Studie an Patienten mit fortgeschrittenem schwarzen Hautkrebs (Melanom) getestet werden. Doch wie belastbar ist dieser Ansatz im Vergleich zum Wettbewerb?

Die Köpfe hinter der Vision

Aus der Taufe gehoben wurde mbiomics im Jahr 2020 von Dr. Laura Figulla, Dr. Johannes B. Wöhrstein und Dr. Markus Rinecker. Während die Mitgründer Figulla und Rinecker das Unternehmen in der frühen Phase prägten, wird die nun anstehende Skalierung und klinische Validierung von einem spezialisierten Leadership-Trio gesteuert:

- Dr. Johannes B. Wöhrstein (CEO & Mitgründer): Als technologischer Kopf und Geschäftsführer verantwortet er die firmeneigene Plattform. Seine Expertise in hochauflösender Analytik ist das Fundament, um komplexe mikrobielle Netzwerke mithilfe von maschinellem Lernen (KI/ML) überhaupt erst zu kartieren.

-

Kristin Torre Vinuesa (CFO): Als Chief Financial Officer verantwortet sie die finanziellen Geschicke des Unternehmens. Ihre Rolle ist entscheidend, um die neu eingeworbenen 30 Millionen Euro strategisch einzusetzen, den naturgemäß hohen Kapitalbedarf der anstehenden klinischen Studien („Cash Burn“) effizient zu steuern und das finanzielle Fundament für zukünftige Runden zu sichern.

- Dr. Christopher Weidenmaier (CSO): Der erfahrene Mikrobiologe (zuvor unter anderem beim US-Konkurrenten Finch Therapeutics) komplettiert das heutige Führungstrio. Als Chief Scientific Officer leitet er die präklinische Forschung und treibt das rationale Design der komplexen Bakterien-Konsortien maßgeblich voran.

Das Problem: Die Unberechenbarkeit der Natur

Um das Geschäftsmodell zu verstehen, muss man den Status quo betrachten. In der Onkologie wird aktuell intensiv mit Stuhltransplantationen (Fecal Microbiota Transplants, FMT) experimentiert. Dabei wird das Mikrobiom von Patient*innen, die hervorragend auf Krebsmedikamente ansprechen, auf „Non-Responder“ übertragen. Die Erfolge sind bemerkenswert, doch das Verfahren hat einen massiven Haken: Stuhl ist ein hochvariables Naturprodukt. Er ist schwer zu standardisieren, birgt Infektionsrisiken und lässt sich nicht als skalierbares Pharma-Produkt im industriellen Maßstab herstellen.

Hier setzt mbiomics mit sogenannten Live Biotherapeutic Products (LBPs) an. Statt auf ungefilterte Spender*innen-Transplantate zu setzen, identifiziert das Team mittels KI genau jene Bakterienstämme, die für den therapeutischen Effekt verantwortlich sind. Diese werden dann im Labor nach pharmazeutischen GMP-Standards gezüchtet und als orale Kapsel verabreicht. Es ist der Versuch, die „Blackbox“ Darm in ein berechenbares, patentierbares Medikament zu verwandeln.

Wo liegen die Risiken?

Für Beobachter*innen der Start-up-Szene bleibt das Vorhaben trotz der Millionen-Finanzierung eine Hochrisiko-Wette. Ein TechBio-Start-up in diesem Stadium hat einen enormen „Cash Burn“. Die 30 Millionen Euro sind ein starkes Fundament, doch die klinische Entwicklung in der Onkologie ist ein Langstreckenlauf, der oft dreistellige Millionenbeträge verschlingt.

Zudem ist das Geschäftsmodell hochgradig binär: Die für 2027 geplante Studie muss erst beweisen, dass die im Labor designten Bakterien-Konsortien im komplexen menschlichen Ökosystem tatsächlich die erhoffte Wirkung zeigen. Ein Scheitern des Leitkandidaten MBX-116 könnte das gesamte Vertrauen in die Plattform erschüttern. Zudem ist die Herstellung lebender Bakterien in absolut reproduzierbarer Qualität eine enorme logistische und biotechnologische Herausforderung, an der bereits andere Pioniere der Branche hängen geblieben sind.

Der Markt: Ein globales Rennen

Mbiomics ist nicht allein auf diesem Feld. Das Unternehmen muss sich gegen hochkapitalisierte internationale Konkurrent*innen behaupten:

- MaaT Pharma (Frankreich): Die Franzosen sind klinisch bereits weiter fortgeschritten und setzen auf „Full-Ecosystem“-Produkte aus gepoolten Spenderproben. Mbiomics muss beweisen, dass ihr synthetischer Präzisions-Ansatz dem natürlichen Mix überlegen ist.

- Vedanta Biosciences (USA): Ein US-Schwergewicht, das ebenfalls definierte Bakterienkonsortien entwickelt und bereits über ein breites Netzwerk an Kooperationen mit der Big-Pharma-Industrie verfügt.

Unsere Einordnung

Für das deutsche Ökosystem ist der Erfolg von mbiomics ein Leuchtturm-Signal. Dass Investoren wie MIG – die bereits bei BioNTech ein frühes Gespür bewiesen – hier massiv nachlegen, unterstreicht die Qualität des Standorts München.

Mbiomics wählt den schwierigen, aber potenziell nachhaltigeren Weg. Statt auf die bloße Kopie der Natur zu setzen, versucht das Team, das Mikrobiom durch Daten beherrschbar zu machen. Gelingt der klinische Wirksamkeitsnachweis ab 2027, könnte das Start-up nicht nur die Onkologie verändern, sondern auch Blaupausen für die Behandlung von Autoimmun- und neurodegenerativen Erkrankungen liefern. Der Weg bis dahin bleibt jedoch teuer und wissenschaftlich riskant.

Tatendrang trifft Struktur – Ist Deutschland wirklich innovationsmüde?

Gründer*innen haben Gestaltungswillen, aber Bürokratie wirkt als tödliche Handbremse. Im Experten-Interview verrät Zukunftsberater und Start-up-Mentor Dr. Jenkis, was sich jetzt ändern muss.

In der öffentlichen Debatte wird Deutschland oft als Land der Bedenkenträger*innen und der bürokratischen Starre gezeichnet. Doch während die Medien über eine allgemeine Verunsicherung berichten, zeigt ein Blick in die Werkstätten und Büros von Gründer*innen und Unternehmer*innen ein anderes Bild: Hier herrscht „Gestaltungslust“ statt Stillstand.

Eine aktuelle Umfrage der ZUKUNFTSWERKE GmbH mit dem Titel „TATENDRANG TRIFFT STRUKTUR: Innovation im Spannungsfeld zwischen Willen und Wirklichkeit“ räumt mit gängigen Klischees auf. Die Ergebnisse belegen, dass der unternehmerische Kern längst auf Aufbruch programmiert ist: 32 Prozent der Befragten treibt der Wille an, die Zukunft aktiv zu gestalten.

Dr. Dirk Jenkis ist Zukunftsberater und Start-up-Mentor sowie der Kopf hinter ZUKUNFTSWERKE und Experte für die Dynamiken zwischen unternehmerischem Willen und strukturellen Rahmenbedingungen. Warum Innovationen oft auf halber Strecke stecken bleiben und warum das Problem weniger in den Köpfen als in den Strukturen liegt, erklärt er im Interview.

Herr Dr. Jenkis, Ihre Studie zeigt: 32 % der Unternehmer*innen wollen Zukunft aktiv gestalten, statt sie nur zu verwalten. Warum klafft die Schere zwischen diesem inneren Tatendrang und der öffentlichen Wahrnehmung einer „lahmenden Wirtschaft“ so weit auseinander?

Dr. Jenkis: Weil wir zwei völlig unterschiedliche Bilder betrachten. Innen sehe ich Unternehmer mit Energie, Ideen und einem klaren Gestaltungswillen. Außen diskutieren wir oft über Symptome: schwaches Wachstum, zähe Prozesse, Unsicherheit. Das Problem ist nicht fehlender Tatendrang. Das Problem ist, dass dieser Tatendrang in einem Umfeld stattfindet, das ihn oftmals ausbremst. Wenn Sie ständig gegen Bürokratie, langsame Verfahren oder unklare Regeln anlaufen, wirkt selbst die dynamischste Organisation irgendwann träge. Die Wirtschaft ist also nicht lahm. Sie läuft nur oft mit angezogener Handbremse.

Mut (27 %) und Neugier (23 %) sind laut Umfrage die wichtigsten Zutaten für Innovation. Warum ist das „Entscheiden ohne vollständige Datenbasis“ heute die wichtigste Kernkompetenz für Gründende?

Dr. Jenkis: Weil die Welt schneller ist als jede Datengrundlage. Wer wartet, bis alles sicher ist, kommt schlicht zu spät. Gründer bewegen sich immer im Ungewissen. Genau dort entsteht Innovation. Mut heißt nicht Leichtsinn, sondern beschreibt die Fähigkeit, mit Unsicherheit produktiv umzugehen.

Und Neugier sorgt dafür, dass man die richtigen Fragen stellt, statt nur auf Antworten zu warten. Die Kombination aus beidem ist entscheidend: neugierig denken, mutig handeln. Wer das beherrscht, hat einen echten Wettbewerbsvorteil.

Ihre Studie weist darauf hin, dass die gefürchtete Risikoaversion oft bei Kapitalgeber*innen und Investor*innen sitzt. Wie pitcht man als Start-up erfolgreich gegen ein Umfeld an, das zwar Innovation fordert, aber offensichtlich Angst vor dem Scheitern hat?

Dr. Jenkis: Indem man Klarheit schafft. Investoren reagieren nicht auf Vision allein, sondern auf nachvollziehbare Logik. Ein guter Pitch verbindet Mut mit Struktur. Er zeigt: Ich weiß, was ich tue, auch wenn ich nicht alles weiß. Gleichzeitig braucht es auf der Investorenseite mehr Bereitschaft, Risiko als Teil von Innovation zu akzeptieren. Kapitel entscheidet mit darüber, wie viel Innovation möglich wird. Wer nur sichere Wetten eingeht, bekommt keine Durchbrüche.

Die größte Bremse ist nicht der mangelnde Wille, sondern fehlende Ressourcen und regulatorische Hürden. Ist der „Innovationsstandort Deutschland“ also eher ein Sanierungsfall der Strukturen als ein Problem der Köpfe?

Dr. Jenkis: Es ist ganz klar ein Strukturthema. Ich habe in den Antworten dieser Studie sehr viel Energie gesehen. Sehr viel Bereitschaft, Verantwortung zu übernehmen und Neues zu schaffen. Was fehlt, sind oft Geschwindigkeit, Verlässlichkeit und Einfachheit im System. Das Gute daran ist aber: Strukturen lassen sich verändern, wesentlich leichter als Mindset. Und genau darin liegt die Chance. Wir müssen nicht erst Motivation erzeugen. Wir müssen die vorhandene Motivation freisetzen und Gründern mehr Steine aus dem Weg räumen.

15 % der Befragten klagen über zu viele Prozesse und zu wenig Freiheitsgrade. Wie bewahren sich Start-ups beim Wachsen ihre Agilität, ohne in die „Konzern-Falle“ zu tappen?

Dr. Jenkis: Die „Konzern-Falle“ entsteht, wenn Prozesse zum Selbstzweck werden. Wachstum braucht Struktur, aber Struktur muss Klarheit schaffen, statt Tempo zu nehmen. Viele Scale-Ups bauen sich schleichend Komplexität auf, die sie später selbst ausbremst. Entscheidend ist, dass Gründer sich mitentwickeln und ihr eigenes System immer wieder hinterfragen. Ohne Widerspruch entsteht schnell eine Echokammer. Agilität bleibt, wenn jemand regelmäßig stört, Fragen stellt und Entscheidungen schärft. Am Ende gilt: Nicht weniger Prozesse machen agil, sondern die richtigen.

77 % der Befragten haben ihr Geschäftsmodell im letzten Jahr grundlegend hinterfragt. Ist eine permanente „positive Paranoia“ heute die einzige Überlebensstrategie?

Dr. Jenkis: Schon 1996 schrieb der Intel-Mitgründer Andy Groove sein Buch mit dem Titel „Only the Paranoid survive“. Ich würde es eher Wachsamkeit nennen. Erfolgreiche Gründer entwickeln schnell ein feines Gespür dafür, wann sich etwas verändert. Sie hinterfragen sich regelmäßig, ohne sich ständig neu zu erfinden. Das ist ein kontinuierlicher Lernmodus. Wer bestehen will, braucht die Fähigkeit, Stabilität und Bewegung gleichzeitig zu organisieren. Das war schon immer so, ist in der schnelllebigen Wirtschaftswelt von heute aber noch wichtiger.

21 % nutzen bewusst externe Impulse und Netzwerke, um Stillstand zu überwinden. Warum ist das „Schmoren im eigenen Saft“ für junge Unternehmen gefährlicher als jede(r) Wettbewerber*in?

Dr. Jenkis: Weil es die Wahrnehmung verengt. Wenn man nur mit Menschen spricht, die ähnlich denken, entstehen schnell Echokammern. Ideen klingen in der eigenen Blase immer besser, als sie wirklich sind. Risiken werden ausgeblendet, blinde Flecken übersehen. Externe Impulse dagegen bringen Reibung. Und genau diese Reibung sorgt für Klarheit. Wer mit offenen Augen und Ohren durch die Welt geht, sich für Neues begeistert und sich bewusst von anderen – etwa Mentoren oder Sparringspartnern – hinterfragen lässt, entwickelt sich weiter. Wettbewerb fordert von außen. Selbstüberschätzung entsteht von innen.

Im „Museum des Scheiterns“ Ihrer Befragten hängen eher leise Fehlentscheidungen wie unpassende Teams oder kulturelle Blockaden. Was ist die wichtigste Lektion, die Gründende aus diesen strukturellen Fehlern ziehen können?

Dr. Jenkis: Erfolg entscheidet sich selten an der Idee. Vielmehr sind es die Menschen und ihre Art, wie sie zusammenarbeiten. Denn die meisten Probleme entstehen nicht spektakulär, sondern schleichend. Falsche Besetzungen, unklare Kommunikation, fehlendes Vertrauen. Die wichtigste Lektion ist deshalb: Organisation und Kultur sind keine Nebenthemen. Sie sind der Kern unternehmerischen Erfolgs. Darum hier nochmal die klassischen Zitate von Peter Drucker und Safi Bahcall: „Culture eats strategy for breakfast. Structure eats culture for lunch.“

Zum Abschluss: Sie ziehen in Ihrer Studie einen Vergleich zur historischen Fernfahrt von Bertha Benz und sagen: Die Ideen stehen bereit, aber der Weg muss frei werden. Wenn wir dieses Bild auf heute übertragen: Welche eine strukturelle Weiche muss die Politik jetzt stellen, damit die nächste große Idee in Deutschland endlich freie Fahrt bekommt?“

Dr. Jenkis: Verlässlichkeit. Unternehmer können mit Unsicherheit umgehen. Was sie brauchen, sind klare, stabile Rahmenbedingungen. Wenn Regeln nachvollziehbar sind und auf Freiheiten bieten, Verfahren schnell laufen und Entscheidungen planbar werden, entsteht automatisch mehr Bewegung. Die Ideen stehen bereit. Die Menschen auch. Jetzt geht es darum, die Straße so zu gestalten, dass sie frei bleibt.

Dr. Jenkis, Danke für die spannenden Insights!

Das Interview führte StartingUp-Chefredakteur Hans Luthardt

Vom Notfallknopf zum KI-Begleiter: Patronus sammelt 11 Mio. Euro ein

Das 2020 von Ben Staudt und Tim Wagner gegründete Berliner Start-up Patronus sichert sich eine weitere Mio.-Finanzierungsspritze für seinen digitalen (Notruf-)Assistenten im Smartwatch-Format. Doch im stark umkämpften Senior*innen-Tech-Markt reicht ein schickes Design allein nicht mehr aus. Ein Blick hinter die Kulissen von Geschäftsmodell, Historie und wachsendem Wettbewerb.

Die Idee zu Patronus entstand aus einem klassischen Alltagsproblem, das viele Familien kennen: Gründer Ben Staudt erlebte bei seiner eigenen Großmutter, dass der traditionelle, klobige Hausnotrufknopf statt um den Hals zu hängen, lediglich als „Nachttischdekoration“ fungierte. Gemeinsam mit Mitgründer Tim Wagner rief er daraufhin im Jahr 2020 das Unternehmen in Berlin ins Leben. Vor der Veröffentlichung ihres ersten Produkts im Jahr 2021 führte das Team nach eigenen Angaben über tausend Gespräche mit potenziellen Nutzer*innen. Die zentrale Erkenntnis: Die Ablehnung herkömmlicher Notrufsysteme ist weniger technischer Natur, sondern vielmehr ein Problem der Würde und Stigmatisierung.

Mittlerweile ist das Team auf 70 Mitarbeitende angewachsen. Nachdem das Start-up in der Vergangenheit bereits eine beachtliche 27-Millionen-Euro-Runde abschließen konnte, fließen nun weitere 11 Millionen Euro Wachstumskapital in das Unternehmen. Bei dieser Runde wird das Konsortium von 3TS Capital Partners angeführt. Begleitet wird die Finanzierung von Grazia Equity sowie Bestandsinvestoren wie Singular, Burda Principal Investments, Adjacent, NAP und UVC Partners.

Das Produkt: Hohe Akzeptanz trifft auf KI-Visionen

Das Kernprodukt von Patronus ist eine Smartwatch, die sich optisch bewusst von klassischer Medizintechnik abhebt, verschiedene Farben bietet und wie eine herkömmliche Armbanduhr wirkt. Ausgestattet mit einer integrierten SIM-Karte stellt sie im Notfall auf Knopfdruck eine sofortige Verbindung zu einer hauseigenen, mit Fachpersonal besetzten 24/7-Notrufzentrale her.

Der nutzer*innenzentrierte Ansatz zeigt laut Unternehmenszahlen deutliche Wirkung:

- Während klassische Hausnotrufgeräte laut Studien nur von 14 Prozent der Nutzer*innen durchgehend getragen werden.

- Liegt die tägliche Tragequote der Patronus-Uhr bei 85 Prozent.

- Mittlerweile verzeichnet das Start-up 25.000 aktive Kund*innen.

- Die hauseigene Zentrale hat für diese Nutzer*innen bereits mehr als eine halbe Million Notrufe beantwortet.

- Parallel dazu verbindet eine eigens entwickelte App 50.000 Angehörige mit den Senior*innen, um deren Status – wie den Standort oder ob die Uhr getragen wird – im Blick zu behalten.

Das frische Kapital fließt nun in den weiteren Ausbau der Marktführerschaft im mobilen Notrufsegment sowie in einen neuen Produktbereich: einen KI-Begleiter. Dieser soll als digitaler Assistent direkt am Handgelenk über die Patronus Uhr verfügbar sein. Da 12 Prozent der über 75-Jährigen in Deutschland an einem durchschnittlichen Tag kein einziges persönliches Gespräch führen, soll der Assistent dem Gefühl der Einsamkeit in stillen Stunden entgegenwirken.

Geschäftsmodell, Markt & Wettbewerb

So glänzend die Zahlen der Pressemitteilung wirken, verlangt das Geschäftsmodell im dynamischen AgeTech-Sektor eine differenzierte Betrachtung:

Der demografische Rückenwind: Der Bedarf an digitalen Lösungen für ältere Menschen wächst rasant. In Deutschland leben heute 9,6 Millionen Menschen im Alter von über 75 Jahren, in ganz Europa sind es 47,4 Millionen. Gleichzeitig nimmt die Zahl der pflegenden Angehörigen ab. Ein immer größerer Anteil will allein leben. Laut Destatis leben in Deutschland bereits 43 Prozent der Menschen über 75 Jahre allein.

Abo-Modell und Kassen-Abhängigkeit: Patronus refinanziert sich maßgeblich über ein Abo-Modell. Ein wesentlicher Wachstumstreiber ist dabei der deutsche Gesundheitsmarkt: Bei Vorliegen eines Pflegegrads kann die Pflegekasse die monatlichen Nutzungsgebühren (die Software, SIM-Karte und Leitstelle abdecken) stark bezuschussen. Ohne diese staatlichen Subventionen hätten viele Senioren Schwierigkeiten, die fortlaufenden Service-Kosten zu tragen. Diese Abhängigkeit von gesundheitspolitischen Rahmenbedingungen bleibt ein strukturelles Risiko.

Der harte Hardware-Wettbewerb: Patronus positioniert sich als digitaler Marktführer im mobilen Notrufsegment in Deutschland. Doch die Konkurrenz holt auf. Dedizierte Senior*innen-Smartwatches anderer Anbieter*innen bieten ebenfalls moderne Designs, SIM-Karten, Notruf-Sprachverbindungen und teils automatische Sturzerkennungen an. Zudem dringen Tech-Giganten tief in den Markt ein: Apple Watches verfügen längst über präzise Sturzerkennungen und EKG-Funktionen und werden zunehmend von technikaffinen "Best Agern" adaptiert. Der langfristige Burggraben von Patronus muss daher zwingend in der nahtlosen, stark vereinfachten Software-Integration und der menschlichen Notrufzentrale liegen – die Hardware allein ist auf Dauer austauschbar.

Das ethische Dilemma der KI: Einsamkeit unter älteren Menschen ist ein anerkanntes Gesundheitsrisiko, das die kognitive Leistungsfähigkeit beeinflussen, das Demenzrisiko erhöhen und die Lebenserwartung verkürzen kann. Die Lösung von Patronus, diesem Problem mit einem KI-Begleiter zu begegnen, ist innovativ, aber ethisch sensibel. Altersforscher warnen davor, dass "künstliche" Gespräche den Drang nach echten sozialen Interaktionen mindern könnten. Dass Patronus selbst betont, der KI-Begleiter solle menschliche Nähe nicht ersetzen, sondern nur eine Antwort für Stunden bieten, in denen niemand da ist, ist ein wichtiger Disclaimer. Dennoch muss das Unternehmen in der Praxis beweisen, dass die KI im sensiblen Pflegeumfeld echte Empathie simulieren kann, ohne die Nutzer*innen zu verwirren.

Unser Fazit

Patronus zeigt, wie man durch konsequentes User-Centric-Design einen verstaubten Markt aufbricht und stigmatisierte Produkte salonfähig macht. Die neuen 11 Millionen Euro geben dem Start-up den nötigen Spielraum für technologische Innovationen. Um die hohe Bewertung nachhaltig zu rechtfertigen, muss Patronus künftig jedoch beweisen, dass der Vorstoß in die künstliche Intelligenz ethisch sauber umgesetzt wird und man dem zunehmenden Hardware-Preisdruck der Wettbewerber*innen standhalten kann.

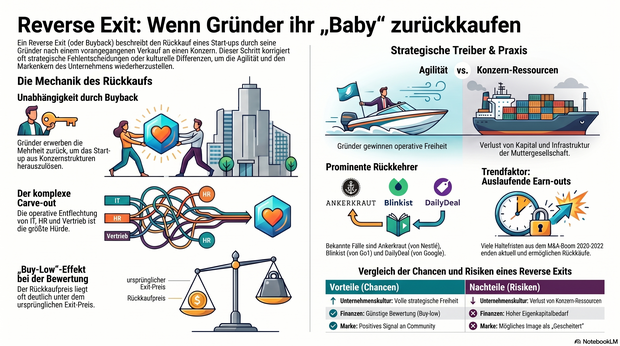

Reverse Exit: Wenn der Exit den Rückwärtsgang einlegt

In jüngster Zeit häufen sich in der Start-up-Szene Fälle, in denen Gründer*innen ihr Lebenswerk nach einem Exit überraschend zurückkaufen. Wir zeigen, was es mit dem Reverse Exit auf sich hat.