Aktuelle Events

Studie: Wie Verbraucher*innen wirklich ticken

Geschwindigkeit ist nicht mehr alles, auch Expert*innenwissen und menschliche Nähe zählen. Das und mehr zeigt die aktuelle Verbraucher*innen-Studie von Twilio und Oxford-Professor Andrew Stephen.

Die Untersuchung wurde von Censuswide mit 8726 Verbraucher*innen in Großbritannien, Frankreich, Deutschland und Spanien zwischen dem 26.05.2022 und dem 07.06.2022 durchgeführt. Die Ergebnisse zeigen, dass die Krise der Lebenshaltungskosten zu neuen Verhaltensweisen und Erwartungen seitens der Verbraucher*innen geführt hat. Daten von über 8.700 Personen aus ganz Europa belegen, dass damit der Druck auf Unternehmen wächst, mit ihren Kund*innen auf sinnvolle Weise in Kontakt zu treten. Die neuen Elemente des Kund*innenerlebnisses folgen einer E3-Formel aus Effizienz, Fachkenntnisse und Emotionen.

Beschleunigt wurde diese Veränderung durch die COVID-19-Pandemie, wirtschaftliche Unsicherheit und rasante technologische Entwicklungen. Um im derzeitigen Wirtschaftsklima erfolgreich zu sein, müssen Unternehmen alle drei Elemente anbieten. Ihre Maßnahmen müssen auf die individuellen Bedürfnisse der Kund*innen zugeschnitten sein, um langfristiges Vertrauen aufzubauen und die Kund*innenbeziehungen in jeder Phase des Lebenszyklus zu verbessern.

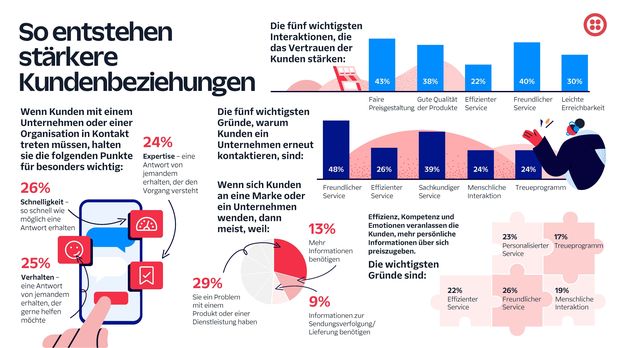

Geschwindigkeit ist bei Weitem nicht alles

Die Studie „The Relationship Economy: Customer Engagement in the Digital Era“ zeigt, dass der Wunsch von Kund*innen nach einem effizienten Service nicht nachgelassen hat: 25 Prozent der Befragten weltweit gaben dies immer noch als ihre wichtigste Priorität an. Der Erfolg von schnellen Lieferoptionen und One-Click-Shopping zeigt, dass Bequemlichkeit nach wie vor im Vordergrund steht. Um wirklich erfolgreich zu sein, sollten Unternehmen ihren Schwerpunkt allerdings nicht nur auf die Geschwindigkeit legen. Die Ergebnisse zeigen, dass es angesichts der Krise beim Aufbau von dauerhaftem Kund*innenvertrauen und anhaltender Loyalität um mehr geht als nur um Geschwindigkeit.

Nach wie vor wünscht sich ein Viertel der Befragten weltweit Effizienz in der Kund*innenbeziehung; daneben nannten 24 Prozent bzw. 25 Prozent weltweit Expertise und Verhalten – oder emotionale Bindung – als ihre wichtigsten Prioritäten. Marken müssen daher über die reine Geschwindigkeit hinausgehen und in Technologien investieren, die alle drei Säulen unterstützen. Mehr Personalisierung hilft bei diesem Spagat, wobei die Kontaktaufnahme auf die Bedürfnisse des Einzelnen in einem bestimmten Kontext zugeschnitten werden sollte. In der beziehungsorientierten Wirtschaft gedeihen starke Kund*innenbeziehungen nur dann, wenn der schnellen Reaktion auch Expertise und emotionale Bindung folgen.

Beziehungsorientierte Wirtschaft braucht Expert*innenwissen

Der Zugang zu Informationen ist im digitalen Zeitalter einfacher denn je; jedoch haben Verbraucher*innen oft Schwierigkeiten, die von den Unternehmen benötigten Antworten zu erhalten. Das kann zu Frustration und Stress führen. Und diesen Gedanken stützt auch die Studie: Wissensbasierte Anfragen waren durchweg am schwierigsten zu erledigen. Nur 13 Prozent der Befragten weltweit fanden es einfach, den/die richtige(n) Logistikpartner*in für einen Kauf zu finden. Mehr noch hatten Schwierigkeiten, Informationen zu Diversität, Gleichberechtigung und Integration oder zur Nachhaltigkeit eines Unternehmens zu finden (12 % bzw. 11,5 %). Eine Engagement-Strategie sollte vorsehen, den Verbraucher*innen Wissen dieser Art zu vermitteln. Das wird den Servicemitarbeiter*innen die Möglichkeit und Zeit bieten, sich auf die komplexeren Anfragen zu konzentrieren, die wirklich einen menschlichen Kontakt erfordern.

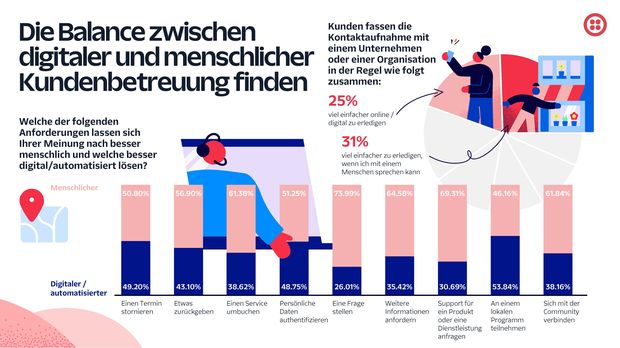

Menschliches und Digitales via bessere emotionale Bindung in Einklang bringen

Langsamere und emotionalere Formen des Engagements sind entscheidend für Unternehmen, die zum Ziel haben, langfristige Beziehungen aufzubauen, die auch dann aufrechterhalten werden, wenn Kund*innen unter finanziellen Druck geraten. Unternehmen, die sich in sensiblen Bereichen wie Finanzen mit ihren Kund*innen auseinandersetzen, gewinnen deren Vertrauen. Das wirkt sich wiederum positiv auf die Kund*innenbindung und Gewinne aus. Auch in diesem Fall ist die Personalisierung von entscheidender Bedeutung. Hier bedeutet sie, dass das Gleichgewicht zwischen menschlicher und digitaler Betreuung auf die individuellen Bedürfnisse zugeschnitten werden kann.

Verbesserte Effizienz ist nach wie vor ein nützlicher Maßstab bei eher transaktionalen Kundenkontakten. „Effizienter Service“ war unter den Befragten weltweit ein häufiger Grund, ein Unternehmen wieder zu nutzen (39 %) oder eine Marke weiterzuempfehlen (37 %). Bei komplexeren oder längerfristigen Interaktionen, wie dem Anschluss an eine Community oder der Bitte um Unterstützung bei Produkten oder Dienstleistungen wünschen sich die Verbraucher*innen jedoch menschliches Einfühlungsvermögen. Auf die Frage, ob sie für diese Aktivitäten digitale oder menschliche Interaktionen bevorzugen, gaben weltweit 74 Prozent bzw. 69 Prozent an, dass sie sich eine menschliche Verbindung wünschen. In ähnlicher Weise nannten die Befragten einen freundlichen Service als beliebtesten Grund für Wiederholungskäufe (42 %) und die Weiterempfehlung einer Marke (37 %). Die Unterstützung dieser Mischung von Bedürfnissen wird den Unternehmen helfen, ihre Kundschaft zu halten – selbst, wenn sie mit wachsendem wirtschaftlichem Druck konfrontiert sind.

Deutsche Verbraucher*innen wünschen sich vor allem Freundlichkeit und Effizienz

Die positive Nachricht vorweg: Der Großteil der Befragten in Deutschland ist der Meinung, dass Marken heute „etwas leichter“ oder „leichter“ zu erreichen sind als früher. Mehr als die Hälfte (69 %) stimmt dieser Aussage zu. Die zwei größten Hürden, ein Unternehmen zu kontaktieren, sind es, einen Agenten zur gewünschten Zeit zu erreichen (28 %) und die lange Wartezeit auf eine Antwort (25 %).

Laut Umfrage werden Unternehmen in Deutschland von ihren Kund*innen vor allem dann kontaktiert, wenn ein Problem mit dem Produkt oder dem Service vorliegt (29 %), mehr Informationen benötigt werden (13 %) oder positives Feedback gegeben werden möchte (13 %). Im Vergleich zu den anderen untersuchten Ländern empfinden deutsche Verbraucher*innen die Kommunikation mit einem Unternehmen über digitale Kanäle genauso zielführend (27 %), als mit einem Mitarbeitenden persönlich zu sprechen (27 %).

Befragte in Großbritannien, Frankreich und Spanien sehen das anders und bevorzugen den persönlichen Kontakt beim Kauf oder in Anspruchnahme einer Dienstleistung (im Durchschnitt 31 %).

Gleichzeitig gaben die Befragten in Deutschland an, dass freundlicher (42 %), effizienter Service (39 %) und die Expertise der Mitarbeitenden (31 %) ausschlaggebend dabei seien, ein Unternehmen erneut zu kontaktieren. Hier wird das Zusammenspiel von Emotion und Effizienz deutlich.

Diese Artikel könnten Sie auch interessieren:

5 Mio. Euro für die „Schreibtischlosen“: Kann Elephant den Frontline-Markt wirklich digitalisieren?

Operative Teams in der Produktion, der Logistik oder im Service gelten bei der Digitalisierung oft als vernachlässigt. Das Berliner Start-up Elephant verspricht Abhilfe durch KI-gestütztes Micro-Learning und sicherte sich dafür nun 5 Millionen Euro. Doch zwischen dem PR-Versprechen und der harten Shopfloor-Realität warten ein eng besetzter Markt und die Gefahr der technologischen Austauschbarkeit.

Die aktuelle Finanzierungsrunde wird von den Corporate-Venture-Capital-Einheiten (CVC) EnBW New Ventures und Wepa angeführt. Dass ausgerechnet diese Player investieren, ist kein Zufall: Die Mutterkonzerne steuern selbst riesige operative Belegschaften. Sie dienen der Elephant Technologies GmbH somit nicht nur als Geldgeber, sondern gleichzeitig als Testlabor und Referenzkund*innen. Ergänzt wird die Runde durch namhafte Angel-Investoren aus dem Umfeld von Flix und Home24.

Das Geschäftsmodell: KI-Kurse gegen das „Wissens-Leck“

Die Gründer Maurice Zomorrodi, Niklas Dehio und Melchior Schramm riefen Elephant im Sommer 2022 ins Leben. Sie adressieren ein strukturelles Problem: Wissen wird in operativen Betrieben oft noch mündlich oder über veraltete Handbücher weitergegeben. Die Elephant-Plattform nutzt einen KI-gestützten „Coursebuilder“, um aus bestehenden Dokumenten mit wenigen Klicks interaktive Lerneinheiten für eine mobile App zu generieren. Ein KI-Assistent soll Fragen zudem kontextbezogen direkt am Arbeitsplatz beantworten. Um Sprachbarrieren in der Industrie abzubauen, bietet das System Übersetzungen in über 95 Sprachen. Dass das Modell Anklang findet, zeigt sich am Solar-Einhorn Enpal, das Elephant zur Schulung von Quereinsteigern nutzt.

Journalistisch betrachtet muss man jedoch das Preisschild hinterfragen: Der Einstieg in die Plattform beginnt bei 640 Euro monatlich für bis zu 50 Nutzer*innen („Team“) und skaliert über 1.300 Euro („Pro“) bis hin zu Enterprise-Lösungen ab 4.000 Euro im Monat. Für Mittelständler*innen ist das ein beachtlicher Kostenblock, der sich zügig durch messbar sinkende Fehlerquoten oder kürzere Onboarding-Zeiten rechtfertigen muss.

Ein Markt im Goldrausch: Wer sind die Jäger*innen?

Elephant ist längst nicht allein auf der Jagd nach der „Deskless Workforce“. Dieses enorme Segment hat in den letzten Jahren mächtige Wettbewerber auf den Plan gerufen. So hat beispielsweise der Branchen-Riese Beekeeper die Frontline-Trainingsplattform eduMe nahtlos in seine App integriert, um Mitarbeitenden Weiterbildung mit nur einem Klick zugänglich zu machen. Solche Konsolidierungen zeigen: Der Standard im operativen Weiterbildungsmarkt wird zunehmend höher.

Zwischen Innovation und Commodity

Trotz des Kapitalschubs steht das Start-up vor zwei entscheidenden Hürden. Erstens droht der technologische Kern – das Umwandeln von PDFs in Quizze mittels KI – zu einer reinen „Commodity“ zu werden. Da große Sprachmodelle (LLMs) rasant mächtiger werden, könnten generische Unternehmenstools diese Funktion bald als Standard-Feature mitliefern. Elephant muss beweisen, dass sich die Plattform unverzichtbar tief in echte Qualitätssicherungs- und Produktionsprozesse verwebt.

Zweitens bleibt der Faktor Mensch das größte Risiko. Software für den Shopfloor scheitert selten am Management, sondern oft an der fehlenden Akzeptanz der Belegschaft. Wenn die App im stressigen Arbeitsalltag nicht als spürbare Entlastung wahrgenommen wird, nützt auch die beste KI wenig.

Unser Fazit

Ein valider Ansatz unter hohem Konkurrenzdruck Elephant hat mit EnBW und Wepa die idealen Partner gefunden, um die Praxistauglichkeit in großen Strukturen unter Beweis zu stellen. Die 5 Millionen Euro geben den nötigen Runway. Dennoch ist der technologische Burggraben schmal. Um langfristig gegen internationale Schwergewichte zu bestehen, muss Elephant mehr sein als nur ein komfortabler Content-Generator. Der echte Härtetest beginnt an der Werkbank.

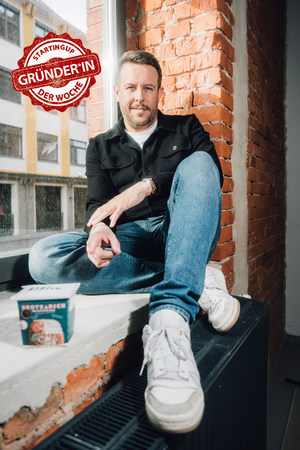

Gründer*in der Woche: Brotrausch – Premium-Teig im recycelten Messbecher

Backen ohne Frust: Wie Brotrausch mit smarten Premium-Mischungen im recycelbaren Messbecher den hart umkämpften DIY-Brotmarkt aufmischen will.

Hinter der 2022 ins Leben gerufenen Marke Brotrausch, die 2023 offiziell an den Start ging, steht heute die Bremer Brot GmbH. Das Unternehmen hat die Marke im Jahr 2025 durch einen Asset Deal übernommen. An der Spitze des Start-ups steht ein Gründer, dessen Wurzeln weit abseits des klassischen Bäckerhandwerks liegen. Philipp Herrnberger, einst in der Sportvermarktung bei Werder Bremen tätig, gründete nicht aus einer entspannten Laune heraus, sondern aus gesundheitlichen Gründen. Nach dem Konsum von herkömmlichem Industrie-Brot kämpfte er immer wieder mit Beschwerden. Sein Antrieb: Ein bekömmliches, transparentes Brot ohne Zusatzstoffe zu kreieren, das man ohne Vorwissen einfach selbst backen kann.

Der Sprung aus der Agenturwelt in die Food-Szene war unkonventionell, doch genau das habe dem Team geholfen, „Dinge anders zu denken“, erinnert sich Herrnberger. In der ersten Phase finanzierte sich das anfänglich fünfköpfige Gesellschafterteam komplett aus eigenen Mitteln. Der Mix aus Bäckermeister, Kaufmann und Kreativen brachte dabei entscheidende Vorteile: „Wir konnten uns voll auf Produkt und Marke konzentrieren, ohne von Anfang an von externen Erwartungen getrieben zu sein“, erklärt der Geschäftsführer. Dennoch räumt er rückblickend offen ein, dass der Bootstrapping-Ansatz an seine Grenzen stieß. „Unter dem Strich muss man sagen, dass wir es ohne externe Investoren nicht geschafft haben“, resümiert Herrnberger über den rettenden Asset-Deal und Neustart im Sommer 2025.

Premium-Teig im recycelten Messbecher

Das Geschäftsmodell hebt sich bewusst vom preissensiblen Massenmarkt ab und richtet sich an all jene, denen im Post-Corona-Alltag schlichtweg die Zeit für aufwändige Sauerteig-Experimente fehlt. Hier setzt das Start-up mit absoluter Convenience an: Die neun natürlichen Brotmischungen erfordern laut Hersteller keinerlei Backerfahrung, kommen gänzlich ohne Küchenmaschine aus und beschränken sich auf rund zehn Minuten aktive Arbeitszeit. Die Zutaten für die „Made in Germany“-Strategie stammen aus kontrolliertem, regionalem Anbau.

Raffiniert und praktisch zugleich ist die Verpackungslösung: Die Mischungen ruhen in einem PET-Becher, der direkt als exakter Messbecher für die benötigte Wasserzugabe dient. Doch gerade ein Plastikbecher weckt in der nachhaltigkeitsgetriebenen Zielgruppe oft Skepsis. Herrnberger verteidigt die Entscheidung leidenschaftlich und verweist auf das rigorose Ausschlussverfahren in der Produktentwicklung. „Kraftpapiertüten sehen offensichtlich nachhaltig aus, wenn sie aber wie für uns beschichtet wären, können sie nur noch verbrannt werden“, kontert der Gründer. Dies sei überhaupt nicht im Sinne der Ressourcenschonung. Stattdessen setzt Brotrausch auf einen vollständig aus recyceltem PET bestehenden Becher einer deutschen Firma. Da die Pappbanderole raffiniert „einschnappt“ und nicht geklebt wird, seien beide Komponenten zu 100 Prozent wiederrecycelbar. Damit sei die Marke auch fit für zukünftige rechtliche Verpackungsvorschriften.

Smarte Nischen und margenstarkes Upselling

Anstatt den oft verlustreichen Preiskampf im regulären Supermarktregal zu suchen, etabliert sich Brotrausch konsequent als D2C-Marke im Premium-Segment. Eine reguläre Brotbackmischung schlägt mit 5,99 Euro zu Buche – eine echte Ansage für ein Produkt, in das die Kundschaft noch Strom, Wasser und Arbeitszeit investieren muss.

„Auf den ersten Blick wirkt der Preis natürlich hoch, vor allem, wenn man ihn rein mit Mehl vergleicht“, gibt Herrnberger zu bedenken. Dieser Vergleich greife jedoch zu kurz. „Wir verkaufen kein Rohprodukt, sondern ein durchdachtes Gesamterlebnis“, betont er und verweist auf die raffinierten Rezepturen und Prozesse, die zu einem Resultat führen, „das viele so zuhause sonst nicht hinbekommen würden“. Die Preisakzeptanz misst das Unternehmen primär über das Feedback und das Kaufverhalten. Als Kund*innen begannen, nicht nur ein zweites Mal zu bestellen, sondern direkt größere Pakete und mehrere Sorten in den Warenkorb legten, wusste das Team: Der Markt akzeptiert den Premium-Aufschlag. Zudem stellt Herrnberger klar: „Im Übrigen kostet das Backen im heimischen und relativ neuen Backofen keine 25 Cent.“

Aus den regulären Supermärkten hat sich Brotrausch mittlerweile bewusst zurückgezogen, da der Kampf um die Regale dort stark über den Preis diktiert wird. „Wir fokussieren uns nun auf Genusspartner wie Weinhändler, Hofläden oder Feinkosthändler, bei denen die Preise hochwertiger Produkte eher akzeptiert werden“, erklärt der Geschäftsführer den strategischen Kurswechsel.

Um die ambitionierte Preisgestaltung zu rechtfertigen, inszeniert das Start-up seine Produkte gezielt als Lifestyle-Upgrade – etwa für das autarke Vanlife beim Camping, als Mitbringsel zum Grillen oder für den Osterbrunch. Flankiert wird das Kernsortiment durch ein lukratives Upselling-Portfolio, das von stilvollen Geschenkboxen für knapp 30 Euro bis hin zu speziellen Baguette-Backblechen, Fruchtaufstrichen und Stullensalzen reicht. Diese Zusatzartikel seien laut Herrnberger zwar nicht essenziell für das Überleben des Unternehmens, da das Brotbacken der Mittelpunkt bleibe, sie seien aber entscheidend für das Wachstum. „Im E-Commerce geht es um den durchschnittlichen Warenkorb und die Retention“, analysiert der Gründer. Das Zusatzsortiment mache das „Erlebnis Brot“ noch intensiver. Der Umsatzanteil dieser lukrativen Extras liegt aktuell bei knapp 15 Prozent.

Die Gretchenfrage der Kund*innenbindung

Dieser strategische Ansatz sichert gesunde Margen und entzieht die Marke geschickt der Vergleichbarkeit mit Discountern. Dennoch bleibt eine große Herausforderung: Der Markt für DIY-Lebensmittel ist durch starke Bio-Traditionsmarken massiv umkämpft. Die größte Hürde besteht darin, die Wiederkaufsrate auf einem profitablen Niveau zu halten. Denn wenn die stylische Mischung primär als originelles Präsent zum Vatertag verschenkt wird, fehlen dem Unternehmen am Ende die wiederkehrenden Alltagsumsätze.

Einen aggressiven Rollout in den stationären Einzelhandel schließt Herrnberger vorerst aus. Dies sei nur mit hohen Investitionen machbar und berge das Risiko, zu einem „One-Hit-Wonder“ zu verkommen. Die Devise lautet stattdessen: „Wir wollen gesund wachsen, um profitabel zu werden.“ Die Geschenkboxen spielen in dieser Strategie eine überraschende Doppelrolle. Sie treffen nicht nur den Zeitgeist, sondern fungieren als cleverer Akquise-Kanal. „Wir erreichen dadurch Menschen, die uns vielleicht noch nicht kennen und unmittelbar mit der Marke, der Qualität und dem Erlebnis in Berührung kommen“, freut sich Herrnberger. Auf diese Weise spare man sich enorme Kund*innenakquisitionskosten. Zudem entwickle sich das Geschenke-Segment zunehmend zu einem echten Profitcenter im B2B-Bereich – etwa wenn Immobilienmakler die Boxen zur Hausübergabe als modernes „Brot und Salz“-Präsent nutzen.

Trotz der starken Nischen-Performance ist klar: Brotrausch muss langfristig beweisen, dass das Premium-Brot aus dem Becher nicht nur an Feiertagen verschenkt wird, sondern den dauerhaften Sprung in die alltägliche Frühstücksroutine der Konsument*innen schafft.

Primogene: 4,1 Mio. Euro für den Muttermilch-Code – Deep-Tech-Innovation oder riskantes Unterfangen?

Das Leipziger BioTech-Start-up Primogene hat eine Seed-Finanzierung in Höhe von 4,1 Mio. Euro eingesammelt, um komplexe bioaktive Moleküle im industriellen Maßstab auf den Markt zu bringen.

Während die Unternehmenskommunikation den Durchbruch einer neuen Plattformtechnologie feiert, zeigt ein genauerer Blick auf den globalen Markt für humane Milcholigosaccharide (HMOs) ein Haifischbecken voller multinationaler Konzerne. Eine kritische Analyse des Geschäftsmodells, der Gründer*innen und des Wettbewerbs.

DeepTech Made in Leipzig

Hinter Primogene stehen Dr.-Ing. Reza Mahour (CEO), Valerian Grote und Linda Karger (COO), die das Unternehmen 2023 in Leipzig gründeten. Die Zusammensetzung des Teams vereint technologische und wissenschaftliche Expertise, um die ehrgeizige Vision einer industriellen Enzym-Produktion umzusetzen. Die aktuelle, 4,1 Millionen Euro starke Seed-Runde wird vom High-Tech Gründerfonds (HTGF) angeführt. Zum Investoren-Konsortium gehören außerdem der Technologiegründerfonds Sachsen (TGFS), better ventures, die Sächsische Beteiligungsgesellschaft (SBG), die Golzern Holding GmbH, die FS Life Science Investment GmbH sowie Dr. Marc Struhalla, Gründer und CEO der c-LEcta GmbH. Der Kapitaleinsatz ist klar definiert: Die neuen Mittel fließen in den Ausbau des IP-Portfolios, die Erweiterung der Produktionskapazitäten in Leipzig und in strategische Partnerschaften.

Das Modell im Stresstest: Die Kostenfalle der Enzyme

Primogene hat eine enzymatische Plattformtechnologie entwickelt, um Inhaltsstoffe zu produzieren, die identisch zu natürlichen Molekülen sind – nachhaltig und kosteneffizient. Im Zentrum stehen dabei komplexe humane Milcholigosaccharide (HMOs) wie Disialyllacto-N-Tetraose (DSLNT) und Difucosyllacto-N-Tetraose I (LNDFH I). Laut Primogene verursachen etablierte fermentative Herstellungsverfahren erhebliche Kosten und stoßen bei der Produktion derartiger hochkomplexer Moleküle an ihre Grenzen.

Der Lackmustest: Die Prämisse, dass enzymatische Verfahren in der Massenproduktion überlegen sind, birgt in der Praxis massive Hürden. Die Entwicklung und wirtschaftliche Produktion der benötigten Enzyme selbst ist extrem kapitalintensiv. Dass das Start-up den gesamten Prozess – von der Enzymentwicklung über die Produktion und Biotransformation bis zur Aufreinigung – komplett am eigenen Unternehmensstandort in Leipzig abbilden will, ist ein ambitionierter, aber riskanter Schritt. Der Aufbau eigener Produktionsanlagen für komplexe BioTech-Prozesse führt oft zu einer enorm hohen Kapitalverbrennungsrate (Burn Rate).

Erste kommerzielle Meilensteine dämpfen dieses Risiko jedoch: Erste Inhaltsstoffe für Kosmetikprodukte wurden mit Kooperationspartnern entwickelt und sind bereits kommerziell erhältlich. Auch pharmazeutische Rohstoffe befinden sich aktuell im Test bei Kund*innen. Zudem erforscht das Unternehmen in Zusammenarbeit mit dem Fraunhofer-Institut für Zelltherapie und Immunologie (IZI) in Leipzig das Potenzial seiner Inhaltsstoffe zur Prävention von Infektionskrankheiten.

Im Haifischbecken: Auf Kollisionskurs mit den Lebensmittel-Riesen

Der Zielmarkt ist hochattraktiv: Der globale HMO-Markt wächst jährlich um etwa 18 bis 20 Prozent, und über 65 Prozent der im Jahr 2023 neu eingeführten Säuglingsnahrungsprodukte enthielten mindestens ein HMO. Neben der Säuglingsernährung bedient Primogene auch Märkte wie die Darmgesundheit bei Erwachsenen, die Gedächtnisverbesserung im Alter sowie funktionale Inhaltsstoffe für Körperpflege und pharmazeutische Rohstoffe.

Das Leipziger Team trifft in der Nahrungsmittelindustrie jedoch auf einen extrem konsolidierten Markt, der von Milliarden-Konzernen dominiert wird. Einer der größten B2B-Zulieferer für Säuglingsnahrung weltweit ist DSM-Firmenich (mit der übernommenen Sparte Glycom), der den Markt durch gigantische Größenvorteile (Economies of Scale) in der Fermentation beherrscht. Auch Chr. Hansen (Jennewein), ein Pionier in der mikrobiellen HMO-Synthese, stellt mit seiner extrem tiefen Integration bei Lebensmittelriesen einen massiven Konkurrenten dar. Auf der Abnehmerseite agieren Endkonsument*innen-Giganten und Branchenführer wie Nestlé und Abbott, bei denen für einen neuen Zulieferer von Inhaltsstoffen extrem hohe regulatorische und volumenbasierte Hürden bestehen.

Primogenes strategische Nische: Ein Preiskampf bei einfach strukturierten Standard-HMOs gegen die großen Fermentations-Player wäre für ein Start-up kaum zu gewinnen. Primogenes entscheidender Wettbewerbsvorteil liegt jedoch in der Komplexität. Die industrielle Produktion von Molekülen wie DSLNT – das laut klinischen Studien signifikante gesundheitliche Vorteile speziell für Frühgeborene bietet – war bislang schlicht nicht möglich. Wenn Primogene hier durch sein starkes Patentportfolio die technologische Lücke schließt, umgeht das Unternehmen den harten Konkurrenzkampf im Massenmarkt.

Unser Fazit: Hohes Risiko, riesiger Hebel

Primogene ist kein schlankes Software-Projekt, sondern waschechtes DeepTech. Das bedeutet: Hohe regulatorische Hürden, langer Atem in der Forschung und massive Kapitalanforderungen. Die Seed-Finanzierung in Höhe von 4,1 Millionen Euro ist ein starker Vertrauensbeweis erfahrener Investoren, wird für den Anlagenbau und die Skalierung der Leipziger Produktion auf Dauer jedoch kaum ausreichen. Primogene muss nun rasch beweisen, dass die enzymatische Synthese nicht nur technologisch überlegen, sondern auch unter realen industriellen Kostendrücken skalierbar ist. Gelingt dieser Proof of Concept, hält das Start-up den Schlüssel zu einer neuen Generation komplexer, bioaktiver Moleküle in der Hand.

110-Mio.-Dollar-Turbo: Sereact verpasst Robotern eine Vorstellungskraft

Mit 110 Mio. Dollar frischem Kapital und „Cortex 2“ greift das Stuttgarter Start-up Sereact die USA an. Die Vision: Roboter, die physikalisch mitdenken, statt nur blind zuzugreifen.

Das 2021 gegründete Stuttgarter Start-up Sereact hat in einer aktuellen Serie-B-Finanzierungsrunde 110 Millionen US-Dollar eingesammelt. Mit dem Versprechen, Industrierobotern durch sogenannte „Weltmodelle“ eine Art situative Vorstellungskraft zu verleihen, zieht das Unternehmen erneut internationale Schwergewichte an. Doch während die Kriegskasse für die anstehende US-Expansion prall gefüllt ist, stellt sich die Frage: Kann der datengetriebene Ansatz aus dem Schwabenland die hochfinanzierte US-Konkurrenz auf ihrem Heimatmarkt wirklich ausstechen? Eine Analyse.

Millionen-Spritze für den Weltmarkt

Die Gründungsgeschichte von Sereact liest sich wie ein europäischer Tech-Traum. Ralf Gulde (CEO) und Marc Tuscher (CTO) starteten 2021 als Ausgründung der Universität Stuttgart. Was mit improvisierten Servern aus gebrauchten Grafikkarten begann, hat sich zu einem globalen Geschäft entwickelt: Nach einer Serie-A-Runde im Jahr 2025 führt nun der VC Headline die 110-Millionen-Dollar-Runde an. Beteiligt sind zudem Bullhound Capital, Daphni und Felix Capital, womit das Gesamtkapital auf über 140 Millionen US-Dollar steigt.

Der Grund für das massive Interesse liegt in der Skalierbarkeit: Mit über 200 europaweit eingesetzten Systemen gilt Sereact als einer der am häufigsten eingesetzten Anbieter von KI-Kommissionierrobotern. Die Kundenliste umfasst Größen wie BMW, Mercedes-Benz, DHL, PepsiCo und die Österreichische Post.

Cortex 2: Denken vor dem Greifen

Bisher basierte der Erfolg auf der Koppelung von Sprachmodellen und Bilderkennung. Mit der neuen Generation „Cortex 2“ geht Sereact einen Schritt weiter: Das System erweitert ein Vision-Language-Action-Modell (VLA) um ein „Weltmodell“. Anstatt nur zu reagieren, gleicht die KI Aktionen mit einem erlernten Modell der Physik ab und wählt den vielversprechendsten Weg aus.

Dieser Wechsel vom Reagieren zum Schlussfolgern ermöglicht komplexe Aufgaben, bei denen feinfühliger Kontakt entscheidend ist – etwa das Zusammenbauen von Komponenten unter Spannung oder das kratzerfreie Anbringen eines Scheibenwischers. CTO Marc Tuscher betont: „Wir bauen keine Roboter. [...] Die Hardware wird zur Massenware. Das Modell nicht.“

Der Eine-Milliarde-Picks-Vorsprung

Sereact positioniert sich als reines Software-Unternehmen, sieht seinen entscheidenden Vorteil jedoch in der Datenqualität. Ein kritischer Blick auf den Markt zeigt:

- Reale Daten vs. Simulation: Während viele Wettbewerber mit simulierten Daten trainieren, wurde Cortex 2 auf Basis von mehr als einer Milliarde realer Greifvorgänge aus der Produktion entwickelt.

- Nachgewiesene Präzision: Sereact begegnet der Skepsis gegenüber KI in der Logistik mit harten Zahlen. Laut Unternehmen erfordert nur noch jeder 53.000. Kommissioniervorgang ein menschliches Eingreifen.

- Hardware-Abhängigkeit: Trotz der Software-Stärke bleibt Sereact darauf angewiesen, dass Kunden in moderne Roboterarme und Sensorsysteme wie die hauseigene „Sereact Lens“ investieren.

Showdown in den USA

Mit der Präsentation auf der MODEX in Atlanta und der geplanten Eröffnung eines Büros in Boston in diesem Sommer bläst Sereact zum Angriff auf den US-Markt. Amerikanische Hersteller fordern produktreife KI, die sofort einsatzbereit ist.

Für die Gründer*innenszene sendet Sereact ein klares Signal: Der nächste Paradigmenwechsel der KI findet in der physischen Welt statt (Embodied AI). Der Erfolg in den USA wird davon abhängen, ob das Stuttgarter Daten-Flywheel auch gegen die gigantischen Budgets der US-Konkurrenz bestehen kann. Sereact hat den Grundstein gelegt, um das „Gehirn“ der globalen Automatisierung zu werden.

Gründer*in der Woche: Vjus.AI – Vom SEO zum GEO

Wie das 2026 von Wolfe Diener gegründete Start-up Vjus.AI den Kampf um die KI-Sichtbarkeit gewinnen will.

Die Ära der klassischen Suchmaschinenoptimierung (SEO) bekommt ernstzunehmende Konkurrenz. Wenn Nutzer*innen heute nach Produkten oder Dienstleistungen suchen, tippen sie ihre Fragen zunehmend in Dialogfenster von Sprachmodellen statt in traditionelle Suchschlitze. Genau an dieser Schnittstelle positioniert sich das neu gestartete Münchner Start-up Vjus.AI. Doch kann eine Software wirklich die „Black Box“ der generativen KI entschlüsseln – und wie nachhaltig ist das Geschäftsmodell?

Hinter der am 1. April 2026 offiziell gelaunchten Plattform steht die AtWize Business Services GmbH mit Sitz in München. Kopf des Unternehmens ist Gründer Wolfe W. Diener, der zuvor bereits in leitenden Positionen als Geschäftsführer und im Vorstand großer Softwarehäuser aktiv war. Mit dem Start von Vjus.AI vollzieht das Unternehmen nun eine strategische Erweiterung in den stark wachsenden Bereich der Answer Engine Optimization (AEO) und Generative Engine Optimization (GEO).

Vom Humankapital zur KI-Sichtbarkeit

Die Historie des Unternehmens ist dabei von einem interessanten Strategiewechsel geprägt. Ursprünglich startete AtWize 2023 mit einem Fokus auf KI-Lösungen gegen den Fachkräftemangel. Diener erklärt die Hintergründe: „Parallel hatte ich schon eine Weile an der Idee arbeitete, Unternehmen zu ermöglichen, ihre in den Ruhestand ausscheidenden Mitarbeiter strukturierter zu managen, um sie bei Bedarf für Projekte oder übergangsweise anzusprechen. Es liegt so viel Humankapital und Erfahrung brach.“ In der aktuellen wirtschaftlichen Phase sei dies jedoch kein Top-Thema gewesen, weshalb man sich zunächst auf die Software-Entwicklung für Dritte konzentriert habe.

Der eigentliche „Aha-Moment“ kam durch die tägliche Arbeit. „Im letzten Jahr haben wir dann immer mehr auch KI-Tools zur Entwicklung eingesetzt und dabei den Bedarf, sogar die Notwendigkeit erkannt, die Sichtbarkeit in KI-Modellen zu messen und zu verbessern“, so Diener. Die Dringlichkeit begründet er mit dem veränderten Nutzer*innenverhalten: „KI-Modelle geben begründete Empfehlungen zur gestellten Frage. Da sucht man nicht weiter, sondern nimmt das Ergebnis wie es ist. Wer da nicht enthalten ist, ist unsichtbar.“

Nutzer*innensimulation: Die reale Perspektive

Vjus.AI setzt auf die Simulation realer Suchanfragen. Während klassische SEO-Tools oft auf APIs zugreifen, misst diese Plattform, wie Marken in Antworten von ChatGPT, Gemini, Grok oder Perplexity tatsächlich erscheinen. Auf die Frage nach der technischen Umsetzung und der Nicht-Deterministik der KI-Modelle antwortet Diener detailliert: „Wenn Sie Ihre Sichtbarkeit bei KI-Suchen wissen wollen, dann sollte diese ja so gemessen werden, wie sie ein normaler Nutzer, der einem KI-Modell eine Frage stellt, einen Prompt eingibt, auch sieht.“ Man müsse also zunächst Prompts definieren, bei denen man gefunden werden wolle – etwa als Münchner Zahnarzt bei der Frage nach dem besten Zahnarzt vor Ort.

„Wir analysieren die Ergebnisse, die von den KI-Modelle auf die Prompts hin geliefert werden“, erklärt Diener weiter. Dabei werden Kennzahlen wie Sichtbarkeit, Ranking und Sentiments (neutrale, positive oder negative Notation) erhoben. Den Vorwurf einer verzerrenden technischen Schicht weist er zurück: „Wir sind insofern keine Zwischenschicht, sondern werten die Daten aus, die viele User auch sehen würden. Die Nicht-Deterministik führt dabei zwar zu kleinen Schwankungen, aber es entsteht insgesamt ja ein Bild über die Zeit.“

Marktchancen und der „Unfair Advantage“

Das Interesse am Markt scheint groß zu sein; bereits vor dem offiziellen Launch konnten erste Kund*innen gewonnen werden. Finanziell steht das Start-up auf eigenen Beinen: „Wir finanzieren uns komplett aus eigenen Mitteln. Und da wir schon Kunden im Entwicklungsbereich haben, konnten wir Vjus.AI früh anwenden und testen“, betont der Gründer. Mit Investor*innen habe man noch nicht gesprochen: „Jetzt erst mal machen, dann reden wir.“

Um sich gegen die großen SEO-Platzhirsche zu behaupten, setzt Diener auf vier spezifische technische Vorteile. Erstens setze man auf eine natürliche Simulation: „Unsere Art des Promptens simuliert wirklich natürliche User. Andere machen das nicht.“ Zweitens komme eine eigene Scraping-Technologie zum Einsatz. Diese erlaube eine besonders detaillierte Analyse der Ergebnisse, auch der „Nebengeräusche“ wie etwa Quellenangaben. Als dritten Punkt nennt der Gründer das analytische Prompting: Vjus.AI unterstützt nicht nur beim Erstellen von Prompts, sondern analysiert auch, wie passend diese für die Sichtbarkeitsmessung sind. Viertens biete das Improver-Modul ein Analyse-Tool, das über die Daten hinweg ermittelt, „was die Haupthebel für das Unternehmen oder die Marke ist, um die Sichtbarkeit bei KI-Suchen zu erhöhen“.

GEO als neues Standard-Tool?

Für die Zukunft sieht Diener eine klare Entwicklung. Zwar werde es in zwei Jahren wahrscheinlich immer noch die klassische Google-Suche geben, doch der Übergang sei bereits fließend, da Google zunehmend KI-Ergebnisse mitliefere. „Die Suche mit KI-Modellen wird aber die gewohnte Praxis werden“, ist sich Diener sicher.

Seine Prognose für die Branche ist deutlich: „Insofern wird SEO eher übergehen in ein GEO. Ein SEO ohne Beachtung der Optimierungen für KI-Modelle macht aus meiner Sicht aber heute schon keinen Sinn mehr.“ Das Ziel für Vjus.AI ist dabei klar gesteckt. Die größte Hürde sei es, für die Nutzer*innen den besten Mehrwert zu generieren: „Darauf liegt unser Fokus und deshalb rennen wir, so schnell wir können.“

M&A im CleanTech-Sektor: SpotmyEnergy übernimmt Zählerhelden

Das 2023 von Jochen Schwill gegründete Kölner Start-up SpotmyEnergy übernimmt den kompletten Messstellenbetrieb des Mitbewerbers Zählerhelden und sichert sich damit rund 3.000 Smart Meter. Der Schritt markiert nicht nur anorganisches Wachstum, sondern verdeutlicht die beginnende Konsolidierung im deutschen Smart-Meter-Markt. Ein genauerer Blick auf die Macher, das Geschäftsmodell und einen Markt, der notorisch hinterherhinkt.

Hinter SpotmyEnergy steht mit Jochen Schwill ein prominenter Kopf der deutschen Energie-Start-up-szene. Schwill, bekannt als Gründer des virtuellen Kraftwerks Next Kraftwerke, rief das CleanTech-Startup im Jahr 2023 in Köln ins Leben. SpotmyEnergy agiert als unabhängiger, wettbewerblicher Messstellenbetreiber. Das Ziel des Unternehmens ist es, den in Deutschland stockenden Ausbau von intelligenten Messsystemen entscheidend zu beschleunigen.

Das Zuhause als virtuelles Kraftwerk

Das reine Aufhängen von Stromzählern ist in einem stark regulierten Markt kaum profitabel. SpotmyEnergy umgeht diese Falle durch einen ganzheitlichen Plattform-Ansatz:

- Hardware & Software: Das Startup liefert Lösungen zur Messung, Vernetzung, Optimierung und Steuerung von Photovoltaikanlagen, Wärmepumpen, Heimspeichern und Wallboxen.

- Drei-Säulen-Modell: Das Unternehmen fungiert als Messstellenbetreiber zur Bereitstellung von Smart Metern, als Energiemanager zur Kostenoptimierung der vernetzten Geräte und als Lieferant mit einem dynamischen Tarif, der Zugang zu aktuellen Börsenstrompreisen bietet.

- B2B2C-Vertrieb: Für den Rollout der Lösungen setzt SpotmyEnergy auf ein Partnernetzwerk, das seit der Firmengründung auf über 300 Elektroinstallationsbetriebe angewachsen ist.

Kritische Hinterfragung

Der Erfolg dieses Modells hängt maßgeblich von der fehlerfreien technischen Integration ab. SpotmyEnergy leistet aktuell Pionierarbeit bei der Einbindung von Steuerboxen, die in Deutschland bislang noch wenig verbreitet sind. Eine Übertragung derartiger Boxen in der aktuellen Größenordnung von 3.000 Stück hat es auf dem deutschen Markt bislang nicht gegeben. Die kritische Frage lautet: Funktionieren die technischen Schnittstellen dauerhaft und herstellerübergreifend reibungslos? Laut Geschäftsführer Schwill wurde mit der Etablierung der technischen Prozesse nun der Grundstein dafür gelegt, dass ein solcher Steuerboxwechsel in der Praxis überhaupt umsetzbar ist.

Markt & Wettbewerb

Deutschland ist beim Thema Smart Meter das Sorgenkind Europas; die Marktdurchdringung ist extrem gering. Dennoch drängen derzeit starke Wettbewerber*innen in die Nische, um sich die digitale Schnittstelle zum Kunden / zur Kundin für die Energiewende zu sichern:

- metrify: Die Enpal-Ausgründung ist mit über 65.000 installierten Systemen der Platzhirsch unter den wettbewerblichen Messstellenbetreibern.

- Inexogy & LichtBlick: Diese Anbieter kooperieren stark mit großen dynamischen Stromanbietern oder agieren als etablierte Ökostrom-Versorger mit eigenen Messstellen-Lösungen.

- Energy Metering Germany (Octopus Energy): Setzen auf gebündelte Angebote, oft gekoppelt an ihre eigenen intelligenten Tarife.

Unsere Einordnung

Die Übernahme des Zählerhelden-Portfolios ist ein strategischer Befreiungsschlag. Für die Kunden von Zählerhelden läuft der Betrieb laut Unternehmensangaben ohne Unterbrechung weiter, sie müssen keine eigenen Schritte einleiten. Die bisherigen Zählerhelden-Gesellschafter, ABM-Mess Service und BSH, konzentrieren sich künftig wieder stärker auf ihre jeweiligen Kerngeschäfte.

Ein hardwarebasiertes, stark reguliertes Geschäftsmodell erfordert extrem tiefe Taschen. SpotmyEnergy wird hierbei vom Investitions- und Strukturierungspartner Horizon Energy Deutschland flankiert, der das Start-up seit Ende des vergangenen Jahres bei der Skalierung unterstützt. Horizon stellt Kapital in Höhe von über 50 Millionen Euro für Smart-Meter-Assets zur Verfügung. Ein Teil dieser zugesicherten Mittel fließt nun direkt in die Übernahme der rund 3.000 Smart Meter von Zählerhelden. Genaue Angaben zum Kaufpreis oder den weiteren finanziellen Übernahmemodalitäten der Transaktion machen die beteiligten Unternehmen jedoch nicht. Wie Emil Bruusgaard, Geschäftsführer von Horizon Energy Deutschland, dennoch treffend analysiert, verdeutlicht die Transaktion anschaulich, wie sich fragmentierte Strukturen im Markt gezielt konsolidieren lassen, um die Grundlage für weiteres Wachstum zu schaffen.

Fazit

Jochen Schwill versucht mit SpotmyEnergy im Endkund*innenbereich das, was ihm im Industriebereich bereits gelang: die digitale Bündelung dezentraler Energieflüsse. Der Zukauf von Zählerhelden beweist eindrucksvoll, dass anorganisches Wachstum in dieser Branche ein essenzieller Hebel ist. Der wettbewerbliche Messstellenbetrieb bietet für ambitionierte Start-ups weiterhin enormes Entwicklungspotenzial.

11 Mio. USD für VisioLab: Stürzt ein Osnabrücker Start-up die Kassen-Dinos?

Das Start-up VisioLab der Gründer an Tim Niekamp und Iwo Gernemann hat den Kassen-Dinos den Kampf angesagt, in dem es den Checkout in Mensen und Arenen durch simple iPad-KI automatisiert.

In der Systemgastronomie, in Mensen und Stadien ist der größte Engpass oft nicht die Küche, sondern die Kasse. Das Osnabrücker Start-up VisioLab adressiert dieses Problem mit künstlicher Intelligenz und verwandelt handelsübliche iPads in voll funktionsfähige Self-Checkout-Systeme. Für die weitere globale Skalierung hat das Unternehmen nun eine Series-A-Finanzierung in Höhe von 11 Millionen US-Dollar abgeschlossen. Angeführt wird die Runde von eCAPITAL Entrepreneurial Partners und Simon Capital, unterstützt von bestehenden Investor*innen wie dem High-Tech Gründerfonds, APX, dem Family Office zwei.7 und Business Angels wie Jens Ohr. Doch wie robust ist dieses scheinbar simple Geschäftsmodell im hart umkämpften Markt der Kassenautomatisierung wirklich?

Aus der Mensa in die NBA: Die Köpfe hinter dem Kassen-Killer

Gegründet wurde VisioLab im Jahr 2019 in Osnabrück von CEO Tim Niekamp und President & COO Iwo Gernemann. Die Idee entsprang einem stark spürbaren Schmerzpunkt in der Gastronomie: Zur Mittagszeit oder in der Halbzeitpause stauen sich die Gäste, während herkömmliche Kassensysteme oft im fünfstelligen Preisbereich liegen und aufwendig geschultes Personal erfordern. Zudem verschärft der chronische Personalmangel in der Foodservice-Branche die Lage massiv.

Die Vision der Gründer war von Beginn an, den Checkout-Prozess durch KI so drastisch zu vereinfachen, dass die zugrundeliegende Technologie im Betrieb kaum noch als solche wahrgenommen wird. Mit einem aktuellen Team von rund 25 Mitarbeitern an den Standorten Osnabrück und Boston haben Niekamp und Gernemann das System iterativ zur Marktreife geführt und internationalisiert. Das frische Kapital soll nun genutzt werden, um das Team auf etwa 40 Mitarbeiter auszubauen – gezielt verstärkt durch ehemalige Führungskräfte von Klarna, SumUp und Google.

Ein iPad als Kassensystem: Geniestreich oder Achillesferse?

Die technische Umsetzung besticht durch Hardware-Minimalismus. VisioLab eliminiert teure, proprietäre Scanner-Kassen und setzt stattdessen auf ein Apple iPad samt Kamera, kombiniert mit einem kompakten Bluetooth-Bezahlterminal und der eigenen KI-App. Die KI erkennt Speisen und Getränke auf dem Tablett in Echtzeit – unabhängig davon, ob diese verpackt oder lose sind. VisioLab vertreibt dieses Setup als "Plug-and-Play"-Lösung direkt als E-Commerce-Produkt über einen Online-Shop. Ein einziges Foto genügt laut Unternehmensangaben, um der KI ein neues Produkt beizubringen, wodurch das System in weniger als fünf Minuten startklar sein soll.

Die fundamentalen Zahlen belegen, dass diese Strategie derzeit voll aufgeht:

- Transaktionen: Weltweit verarbeiten rund 500 Installationen etwa eine Million Transaktionen im Monat.

- Gesamtvolumen: Das kumulierte Transaktionsvolumen liegt mittlerweile bei knapp 100 Millionen US-Dollar.

- Wirtschaftlichkeit: Im vergangenen Quartal verzeichnete das Unternehmen erstmals einen positiven Cashflow.

Kritisch hinterfragt

Der Verzicht auf stark spezialisierte Hardware ist ein zweischneidiges Schwert. Einerseits ermöglicht es VisioLab eine enorme Vertriebsgeschwindigkeit ohne große Hardware-Vorfinanzierungen und langwierige Installationen. Andererseits ist die rein kamerabasierte 2D-Erkennung auf einem handelsüblichen Tablet potenziell anfällig für komplexe Lichtverhältnisse oder optisch nahezu identische Gerichte. Zudem begibt sich das Start-up in eine absolute Abhängigkeit vom Apple-Ökosystem. Das Geschäftsmodell erfordert eine konstante technologische Weiterentwicklung, um die "Churn-Rate" (Kund*innenabwanderung) gering zu halten, da die Wechselkosten für Gastronom*innen bei einer reinen iPad-Lösung verhältnismäßig niedrig sind.

Der Kampf um die Food-Erkennung

Der globale Markt für "AI Food Recognition" und Self-Checkout erlebt derzeit einen massiven Schub. VisioLab hat sich in diesem Umfeld geschickt in lukrativen, hochfrequentierten Nischen positioniert:

- Sport & Entertainment: In den USA stattet VisioLab beispielsweise die Arena des NBA-Teams Orlando Magic mit 43 Systemen aus und deckt damit fast das gesamte Stadion ab. Weitere Kunden sind die NFL-Teams Atlanta Falcons und Carolina Panthers sowie der Fußballclub Inter Miami.

- Bildung & Corporate: Etwa jeder dritte deutsche Uni-Campus nutzt die Technologie über die Studierendenwerke. Hinzu kommen Betriebskantinen von DAX-Konzernen und Kooperationen mit globalen Caterern wie der Compass Group und Aramark.

Allerdings agiert VisioLab nicht konkurrenzlos. Der Wettbewerb ist technologisch divers und hochkapitalisiert. Das US-Start-up Mashgin gilt als einer der härtesten globalen Konkurrenten. Im Gegensatz zu VisioLab setzt Mashgin auf spezielle Kiosk-Terminals mit multiplen 3D-Kameras. Das erhöht zwar die Hardwarekosten und den Installationsaufwand drastisch, verspricht aber eine extrem hohe Erkennungsgenauigkeit selbst bei chaotischen Objektanordnungen. Auch auf dem Heimatmarkt gibt es mit Start-ups wie auvisus ("VisionCheckout") starke Wettbewerber*innen, die ebenfalls KI-Bilderkennung für Betriebsrestaurants und Kantinen anbieten.

Fazit: Hyperwachstum mit Haken

Für die Start-up-Szene liefert VisioLab ein beeindruckendes Beispiel dafür, wie kluges "Go-to-Market"-Design aussieht. Anstatt den kapitalintensiven Weg proprietärer Hardware-Entwicklung zu gehen, nutzt das Team Standard-Consumer-Hardware und fokussiert die gesamte Wertschöpfung auf die smarte KI-Software am Endgerät.

Diese agile Entscheidung ermöglicht das derzeitige Hyperwachstum: Das US-Geschäft steuert bereits rund 50 Prozent zum Umsatz bei und wächst jährlich um über 1.000 Prozent. Mit dem frischen Kapital, dem Ausbau des US-Standorts durch Co-Founder Iwo Gernemann sowie der gezielten Expansion nach Australien, Neuseeland, Österreich, Großbritannien und in die Niederlande stellt VisioLab die Weichen auf globale Skalierung.

Ob das Osnabrücker Start-up langfristig gegen bestens finanzierte US-Giganten und 3D-Kamera-Spezialisten bestehen kann, wird sich an der Robustheit der Software im massenhaften Dauerbetrieb zeigen. Gelingt es VisioLab, durch kontinuierliches KI-Training seinen Genauigkeits- und "Plug-and-Play"-Vorteil auszubauen, hat das Team hervorragende Chancen, den Checkout-Prozess in der Systemgastronomie dauerhaft zu dominieren.

Brainjo: 2-Mio-EUR-Spritze für die Therapie-Brille

Lange Wartelisten und ein überlastetes Gesundheitssystem: Das Regensburger Start-up brainjo will die Lücken in der klassischen Psychotherapie mit Virtual Reality (VR) schließen.

Das Digital-Health-Start-up brainjo hat erfolgreich eine Seed-Finanzierung in Höhe von zwei Millionen Euro abgeschlossen. Angeführt wird die Finanzierungsrunde vom High-Tech Gründerfonds (HTGF). Zu den weiteren Geldgebern gehören die MEDICE Health Family als strategischer Partner sowie Business Angels, darunter der Regensburger Investor Andreas Weinhut und der Münchner VC better ventures. Mit dem frischen Kapital finanziert das Unternehmen den Start einer klinischen Studie und treibt die Zulassung seiner ersten digitalen Gesundheitsanwendung (DiGA) voran.

Von der Studenten-Idee zum Digital-Health-Start-up

Hinter brainjo steht ein zehnköpfiges, interdisziplinäres Team, das Expertise aus den Bereichen Technologie, Psychologie und Gesundheit vereint. Gegründet wurde die brainjo GmbH im Jahr 2022 mit Sitz in Regensburg. Die Wurzeln des Unternehmens liegen in einem Ausgründungsprojekt der Ostbayerischen Technischen Hochschule (OTH) Regensburg. Die Gründer – allen voran Christian Gnerlich, Alexander Pilling und Constantin Demigha – begannen bereits 2021 in der lokalen TechBase mit der Vision, Gehirntraining durch Virtual Reality greifbar zu machen.

Was als Projekt für generelle "Mental Fitness" startete, hat sich mittlerweile zu einem klinisch fundierten Ansatz im Bereich Digital Health weiterentwickelt. Heute lenken Markus Wensauer (Co-Founder und CEO) und Christian Gnerlich das operative Geschäft, während Alexander Pilling die VR-Entwicklung verantwortet.

Das Produkt: Psychotherapie im Gaming-Gewand

Brainjo entwickelt VR-basierte DiGAs für die Psychotherapie. Diese sollen künftig von Therapeut*innen oder Ärzt*innen verordnet und von den Krankenkassen erstattet werden. Der Ansatz des Start-ups ist es nicht, die klassische Psychotherapie zu ersetzen, sondern die teils gravierenden Versorgungslücken des Systems zu schließen. Patient*innen sollen so von zuhause aus Zugang zu einer immersiven und individualisierten Behandlungsform erhalten.

Die erste Anwendung richtet sich an Kinder mit ADHS und entsteht in direkter Kooperation mit der MEDICE Health Family. Um die oft geringe Therapiemotivation der jungen Zielgruppe zu knacken, setzt brainjo stark auf Gamification. Die Kinder tauchen per VR in virtuelle Welten ein und trainieren dort durch spielerische Elemente Alltagssituationen und kognitive Fähigkeiten. Laut HTGF-Principal Dr. Jörg Traub unterscheidet sich das Start-up genau durch diese Tiefe der Immersion von reinen Software-Lösungen, was einen klinisch relevanten Ansatz darstelle, um die Therapietreue (Adhärenz) signifikant zu steigern.

Der strategische Schachzug von MEDICE

Der Markt für Therapie auf Rezept (DiGA) ist in Deutschland stark umkämpft. Im Segment ADHS formiert sich bereits handfeste Konkurrenz:

- Bei Erwachsenen: Im Sommer 2025 wurde mit der App ORIKO (entwickelt von Takeda und MiNDNET) die erste DiGA für erwachsene ADHS-Patient*innen in das offizielle Verzeichnis des Bundesinstituts für Arzneimittel und Medizinprodukte (BfArM) aufgenommen.

- Im Kinder- und Jugendbereich: Mit hiToco existiert bereits ein etabliertes, Smartphone-basiertes Elterntraining für Kinder zwischen 4 und 11 Jahren (Zulassung ebenfalls Mitte 2025).

Besonders interessant: Hinter hiToco steht die medigital GmbH – eine Tochter der MEDICE Health Family. Der Einstieg von MEDICE bei brainjo ist daher mehr als nur ein finanzielles Investment. Der Pharmakonzern baut sich hier offensichtlich ein lückenloses, digitales ADHS-Ökosystem auf: hiToco für die Schulung der Eltern, brainjo für die direkte VR-Therapie der Kinder.

Unsere Einordnung

Der technologische Ansatz von brainjo ist vielversprechend und adressiert mit langen Wartelisten in der Psychotherapie ein massives gesellschaftliches Problem. Die strategische Einbettung in das MEDICE-Portfolio ist ein cleverer Hebel. Dennoch muss sich das Modell in den kommenden Jahren harten Herausforderungen stellen:

- Die Hardware-Hürde: Anders als eine einfache Smartphone-App erfordert die Lösung von brainjo teure VR-Brillen. Wer bezahlt die Hardware? Krankenkassen übernehmen in der Regel nur die Kosten für die reine DiGA-Nutzungslizenz. Wenn Eltern in Vorleistung gehen müssen oder ein aufwendiges Leih-System etabliert werden muss, verliert die Therapie ihren propagierten skalierbaren und einfachen Zugang.

- Zulassung und Zeitplan: Die Marktzulassung ist erst für 2028 geplant. Im schnelllebigen Start-up-Sektor ist das eine halbe Ewigkeit. Bis dahin muss brainjo mit den frischen zwei Millionen Euro den Betrieb sichern und vor allem die anstehende klinische Studie erfolgreich durchführen. Ohne wasserdichte Evidenzdaten platzt der Traum der BfArM-Zulassung.

- Akzeptanz bei Eltern und Behandler*innen: Eine immersive VR-Welt löst bei Kindern Begeisterung aus – bei Eltern potenziell Skepsis. Das Team muss pädagogisch überzeugend belegen, dass die zusätzliche „Bildschirmzeit“ unter der Brille einen rein therapeutischen Zweck erfüllt und eine ohnehin bestehende Reizüberflutung bei ADHS-Patient*innen nicht noch verstärkt.

Fazit

Brainjo verlässt die ausgetretenen Pfade der 2D-Apps und wagt sich an die hochkomplexe Schnittstelle zwischen VR-Hardware, Gaming und klinischer Therapie. Gelingt der klinische Wirksamkeitsnachweis und lässt sich die Verteilung der Hardware logistisch reibungslos organisieren, könnte das Start-up die Psychotherapie nachhaltig verändern. Bis 2028 bleibt dieses Vorhaben jedoch ein kapitalintensiver Ausdauerlauf.

Openlaw sichert sich 3,3 Mio. US-Dollar für digitale Rechtsinfrastruktur

3,3 Mio. USD gegen Europas Bürokratie: Das LegalTech-Start-up Openlaw automatisiert mit beglaubigt.de den Gründungsprozess als digitale Infrastruktur.

Die europäische Plattform für digitale Rechts- und Notarinfrastruktur Openlaw hat eine Seed-Finanzierungsrunde in Höhe von 3,3 Millionen US-Dollar abgeschlossen. Das 2024 gegründete Münchner LegalTech-Start-up, das im Heimatmarkt vor allem unter der Marke beglaubigt.de agiert, will mit dem frischen Kapital den bürokratischen Gründungs- und Verwaltungsprozess in Europa radikal vereinfachen. Zu den Geldgebern zählen unter anderem YouTube-Mitgründer Jawed Karim über Y Ventures, Moonfire Ventures (gegründet von Atomico-Cofounder Mattias Ljungman), Zeno Ventures, Combination VC, Orange Collective sowie diverse Business Angels und Alumni des Y Combinators.

Von der Unicorn-Skalierung zur Infrastruktur: Die Gründerhistorie

Hinter Openlaw stehen zwei Köpfe mit beachtlicher Start-up-Vita, die den Schmerz der europäischen Bürokratie aus eigenen Gründungs- und Skalierungsphasen kennen:

Alexander Sporenberg (CEO): Er gehörte zum Gründungsteam der Razor Group, einem E-Commerce-Aggregator, der in nur 15 Monaten zum Unicorn mit einer Bewertung von 1,7 Milliarden US-Dollar aufstieg. Bei hunderten M&A-Deals erlebte Sporenberg Notartermine und Registerprozesse als massives Nadelöhr für das Unternehmenswachstum.

Felix Gerlach (CPO): Nach seiner Zeit im Ökosystem von Rocket Internet gründete Gerlach die Identity-Verification-Plattform Passbase. Nachdem internationale US-Investoren einstiegen, wurde das Unternehmen 2023 an Parallel Markets verkauft. Seine Expertise im Aufbau skalierbarer Infrastrukturen fließt nun in die Produktentwicklung bei Openlaw.

Mit diesem Background schaffte es das Duo in das hochkompetitive Programm des kalifornischen Y Combinators (F24 Batch). Durch die Zeit in San Francisco verfestigte sich die Vision, die technologische Lücke zwischen dem US-Markt, wo Gründungen teils in nur 24 Stunden abgeschlossen sind, und dem europäischen Flickenteppich aus 27 Rechtssystemen und über 60 Gesellschaftsformen zu schließen.

API-First statt Papierkrieg

Das Kernversprechen von beglaubigt.de ist eine drastische Effizienzsteigerung durch die Digitalisierung des administrativen Überbaus. Während eine reguläre GmbH-Gründung in Deutschland meist sechs bis acht Wochen in Anspruch nimmt, will Openlaw diesen Prozess laut eigenen Angaben auf bis zu drei Tage drücken.

Dabei agiert das Start-up explizit nicht als Ersatz für bestehende Institutionen. Vielmehr fungiert das Modell als prozessoptimierende Schicht für Gründer*innen:

Die Plattform übernimmt die Administration, die Terminkoordination, die Dokumentenvorbereitung sowie die Registeranmeldungen. Dafür arbeitet beglaubigt.de regelmäßig mit einem Netzwerk aus rund 300 Notariaten zusammen. Die originär hoheitlichen Aufgaben – die juristische Beratung, rechtliche Belehrung und die eigentliche Beurkundung – verbleiben zwingend bei den kooperierenden Notariaten.

Ein wesentlicher USP und Skalierungshebel ist die technologische Anbindung an Drittanbieter. Openlaw betreibt eine vollautomatisierte "Incorporation API". Diese erlaubt es Partnern wie den Neobanken Qonto und Holvi oder dem Buchhaltungstool Sevdesk, den gesamten Gründungsprozess nativ in ihre eigenen Workflows zu integrieren. Ein(e) Kund*in kann so beispielsweise im Rahmen einer Kontoeröffnung bei Qonto direkt die Unternehmensgründung mit anstoßen, ohne die Plattform wechseln zu müssen. Bis heute hat das rund 20-köpfige Team nach eigenen Unternehmensangaben über 25.000 Kund*innen über die Plattform betreut.

Marktumfeld und Wettbewerb

Dass eine Beschleunigung im Ökosystem not tut, ist unumstritten. Laut dem DIHK-Report 2025 sind beinahe 60 Prozent der Gründer*innen mit dem Standort Deutschland unzufrieden; drei Viertel fordern deutlich schnellere und einfachere Regularien. Die Politik versucht zwar auf europäischer Ebene, mit Vorstößen wie der EU Inc. die Entbürokratisierung voranzutreiben. Doch was nach der eigentlichen Gründung folgt – wie Steuerregistrierung, Handelsregister, Geschäftsadresse und laufende Administration – bleibt hochkomplex und national geregelt. Zudem muss in Kernmärkten wie Deutschland, Spanien und Frankreich die Unternehmensgründung notariell beurkundet werden.

In diesem Setup muss sich das Geschäftsmodell von Openlaw bewähren und kritischen Fragen stellen:

- Der harte Flaschenhals des Notarmonopols: So reibungslos Openlaw den Prozess per Software orchestriert, am Ende bleibt das Tempo durch die Kapazitäten der angeschlossenen Notariate und Amtsgerichte limitiert. Openlaw optimiert den Weg zum und vom Notariat sowie den administrativen Overhead, kann die Institution selbst aufgrund gesetzlicher Vorgaben aber nicht disruptieren.

- Dicht besiedelter Wettbewerb: Der Markt für „Gründung als Service“ in Deutschland ist umkämpft. Etablierte Player wie firma.de, Rechtstech-Kanzleien (z.B. Recht24/7) oder hochspezialisierte Anbieter wie RIDE (Fokus auf vermögensverwaltende GmbHs und Holding-Strukturen) bedienen die Sehnsucht nach administrativen Abkürzungen schon länger.

- Der strategische Vorteil durch B2B: Der entscheidende Differenzierungsfaktor von Openlaw scheint weniger das Endkund*innengeschäft zu sein, sondern der radikale API-First-Ansatz. Gelingt es, die eigene Schnittstelle als unsichtbare Standard-Infrastruktur in europäische FinTech-Lösungen und Banking-Apps einzuweben, profitiert Openlaw von massiven Lock-in-Effekten und senkt gleichzeitig die Customer Acquisition Costs (CAC), da Partner wie Qonto oder Sevdesk den Traffic liefern.

Ausblick

Mit dem frischen Kapital will Openlaw das Produktangebot seiner deutschen Marke gezielt ausbauen. Neben Standardgründungen (GmbH, UG, GbR) und steueroptimierten Holding-Strukturen sollen künftig auch weitere Registerprozesse sowie die laufende Buchführung vollständig über die Plattform abgewickelt werden. Das langfristige Ziel bleibt dabei die Expansion in weitere europäische Märkte, um Gründer*innen eine grenzübergreifende digitale Infrastruktur für den laufenden Betrieb zu bieten.

Strategischer Exit: food42morrow übergibt seine Getränkemarke JUMA an die Berentzen-Gruppe

Die Konsolidierung im Markt für funktionale Getränke setzt sich fort: die 2022 gegründete food42morrow GmbH übergibt ihre Marke JUMA im Rahmen eines strategischen Exits an die Vivaris Getränke GmbH & Co. KG, eine Tochtergesellschaft der börsennotierten Berentzen-Gruppe Aktiengesellschaft. Ab Mai 2026 soll die großflächige Skalierung unter der Flagge von Vivaris als JUMA Recharge+ erfolgen.

Die food42morrow GmbH wurde 2022 in Frankfurt am Main mit dem Ziel gegründet, Marktlücken im Bereich Functional Food durch wissenschaftlich fundierte und trendorientierte Konzepte zu schließen. Die Gründer Raoul Kammann, Max Kammann und Carlos Lopez Granado entwickelten mit JUMA eine Antwort auf die steigende Nachfrage nach natürlichen Wachmachern.

Das Kernprodukt RECHARGE+ ist ein teebasierter Hydration Drink, der Elektrolyte, Vitamine und natürliches Koffein (u. a. aus Guayusa) kombiniert. Der Fokus liegt hierbei auf einer Funktionalität ohne Zuckerzusatz, die speziell auf die Bedürfnisse einer urbanen, aktiven Zielgruppe zugeschnitten ist. Bereits 2025 konnte das Start-up die Marktfähigkeit durch erste Listungen im deutschen Lebensmitteleinzelhandel (LEH) nachweisen.

Packaging-Innovation als strategischer Hebel

Ein wesentliches Alleinstellungsmerkmal, das den Exit maßgeblich begünstigt haben dürfte, ist das innovative Gebinde. food42morrow brachte als erstes Unternehmen in Deutschland eine wiederverschließbare Aluminiumflasche mit Schraubverschluss in dieser Kategorie auf den Markt. Diese Verpackung kombiniert die hohe Recyclingquote von Aluminium mit der Flexibilität einer Flasche. Für etablierte Konzerne wie die Berentzen-Gruppe stellt eine solche bereits validierte „Hardware-Innovation“ einen hohen Wert dar, da sie das Risiko bei der Markteinführung neuer Kategorien senkt.

Einordnung: Die „Evolve 2030“-Strategie

Der Zukauf durch die Berentzen-Gruppe ist kein Zufall, sondern Teil einer breiteren Branchenbewegung. Mit der Strategie BERENTZEN EVOLVE 2030 reagiert der Konzern auf den rückläufigen Spirituosenkonsum und investiert massiv in das Segment der alkoholfreien Getränke (AfG). JUMA fungiert hierbei als Portfolio-Ergänzung im margenstarken Premium-Bereich der funktionalen Drinks. Ähnliche Strategien verfolgten zuletzt auch Akteure wie Eckes-Granini oder die Paulaner-Gruppe bei der Integration agiler Innovationsmarken.

Key Learnings für Gründer*innen

Aus dem Case food42morrow lassen sich drei zentrale Erkenntnisse für die Skalierung von Konsumgüter-Start-ups ableiten:

- USP durch Packaging: In einem gesättigten Markt reicht ein guter Inhalt oft nicht aus. Eine technologische oder funktionale Innovation bei der Verpackung kann der entscheidende Türöffner für den LEH und für Akquisitionsgespräche sein.

- Validierung vor Skalierung: Der Exit erfolgte erst, nachdem die Marktfähigkeit (Proof of Market) durch erste Listungen 2025 bewiesen war. Große Player kaufen bevorzugt Marken, die ihre „Kinderkrankheiten“ bereits überwunden haben.

- Positionierung als „Brückenbauer“: food42morrow hat sich erfolgreich als Bindeglied zwischen Start-up-Agilität und industrieller Skalierung positioniert. Dies ermöglicht es den Gründern, sich auf ihre Kernkompetenz – die Produktentwicklung – zu konzentrieren, während die massive Distribution durch die Strukturen eines Konzerns erfolgt.

Was kommt nach JUMA?

Mit der Übergabe der Marke an Vivaris stellt food42morrow seine Kompetenz als Innovationstaktgeber unter Beweis. Bleibt die spannende Frage, welche Trends das Frankfurter Team als Nächstes identifiziert.

Steckrübe statt Schwein: Verrano sichert sich hohe sechsstellige Finanzierung für die „Clean Label“-Revolution

Das 2023 gegründete Frankfurter Start-up Verrano hat ein neuartiges Verfahren entwickelt, das regionales Wurzelgemüse durch Reifung und Räucherung in eine pflanzliche Alternative zu Wurstersatzprodukten verwandelt.

Hinter Verrano, das Anfang 2023 in Frankurt/Main gegründet wurde, steht ein branchenerfahrenes, dreiköpfiges Gründerteam rund um Geschäftsführer Manuel Siskowski. Die Idee reifte jedoch schon lange vor der formellen Gründung. Getreu dem internen Motto „natürlich köstlich“ experimentierten die Gründer – zu denen auch Maximilian Bubenheim mit seiner Erfahrung aus der Sternegastronomie sowie Felix Linnenschmidt gehören – mehrere Jahre mit Wurzelgemüse.

Dabei wendeten sie ein Verfahren an, das in ähnlicher Form beim Reifen von klassischem Schinken zum Einsatz kommt. Nach ersten erfolgreichen Testläufen im regionalen Bio-Handel konnten bald die ersten Kund*innen mit Mengen aus der in Biebertal bei Gießen installierten Pilotanlage beliefert werden.

Handwerkstradition trifft Gemüse

Anstatt klassische Fleischersatzprodukte nachzuahmen, setzt Verrano auf die handwerkliche Veredelung. Regionale Rohstoffe wie Steckrübe, Sellerie und Rote Beete werden einem speziellen Fermentations- und Räucherverfahren unterzogen. Das Endprodukt zeichnet sich durch einen enormen Gemüseanteil von rund 95 Prozent aus und kommt mit nur wenigen Zutaten aus, ohne künstliche Zusatzstoffe zu verwenden. Das Ergebnis soll laut Unternehmensangaben in seiner Textur und dem Geschmack an hochwertige Fleischprodukte wie Schinken erinnern. Die kulinarischen Kreationen werden bereits als dünner Aufschnitt, im Würfelmix oder am Stück in den Markt eingeführt und eignen sich flexibel als Brotbelag, zum Kochen oder für Snackplatten. Die Innovationskraft dieses Ansatzes wurde kürzlich von PETA mit dem „VEGAN AWARD 2026“ in der Kategorie „beste vegane Innovation“ ausgezeichnet.

Eine neue Kategorie jenseits der Imitation

Der Markt für pflanzliche Alternativen konsolidiert sich aktuell, während die Lebensmittelbranche verstärkt nach innovativen pflanzlichen Produkten sucht, die neue Geschmackserlebnisse erzeugen. Hier positioniert sich Verrano in der stark wachsenden Nische der „Clean Label“-Produkte. Direkte Wettbewerber*innen mit einem identischen Ansatz sind rar, da die meisten großen Player*innen weiterhin auf Extrusionsverfahren von Proteinisolaten setzen. Verrano erschafft vielmehr eine neue Kategorie: Eine pflanzliche Feinkost, die das Naturprodukt Gemüse transformiert. Dass diese Nische massentauglich ist, bewies das Start-up jüngst im Veganuary durch aufmerksamkeitsstarke Listungen deutschlandweit in den Bordbistros der Deutschen Bahn.

Die Herausforderungen am Markt

Trotz der vielversprechenden Traction und der Skalierbarkeit, die bereits mit der Pilotanlage bewiesen wurde, steht das Start-up vor großen operativen Herausforderungen, um den Start im breiten Handel zu ermöglichen. Ein Reifeprozess, der Wochen in Anspruch nimmt, bindet extrem viel Working Capital, da enorme Mengen vorproduziert und gelagert werden müssen. Zudem verhält sich Gemüse im Reifeprozess mikrobiologisch grundlegend anders als Fleisch. Die Qualitätssicherung erfordert hochpräzise Produktionsumgebungen, um die Haltbarkeit bei größeren Mengen zu garantieren. Letztlich bedarf es auch starker Aufklärungsarbeit und forcierter Vertriebsaktivitäten am Konsument*innen, um Wurzelgemüse dauerhaft als Premium-Feinkostprodukt zu etablieren.

Reale Skalierung statt VC-Hype

Genau bei diesen Herausforderungen zeigt sich die strategische Passung der aktuellen Finanzierungsrunde. Dass Verrano die bestehenden Produktionskapazitäten massiv ausweiten muss, um die ansteigende Nachfrage zu bedienen, ist der klassische Flaschenhals von Food-Start-ups. Der überwiegende Teil der eingeworbenen Mittel fließt in genau diesen Zweck. Dass die Finanzierungsrunde dabei, wie StartingUp aus Branchenkreisen erfuhr, im hohen sechsstelligen Bereich liegt, beweist die Kapitaleffizienz des Unternehmens. Anstatt reines Risikokapital in teure Eigenentwicklungen zu pumpen, setzt Verrano auf „Smart Money“.

Mit dem Maschinenbauer Weber Food Technology und der Wurst- und Schinkenmanufaktur Bedford holen sie sich zwei strategische Industrie-Schwergewichte an Bord. Verrano profitiert hier direkt von jahrzehntelanger Expertise in der mikrobiologischen Reifung sowie im industriellen High-Tech-Slicing. Zusammen mit der BMH, die als VC-Tochter der Helaba aktuell Fonds mit einem Volumen von 450 Millionen Euro verwaltet, hat das Start-up starke Partner für die anstehende Geschäftsentwicklung gewonnen. Dieses Konsortium bietet das Rüstzeug, um die Nische der veganen Boutiquen zu verlassen und den Lebensmitteleinzelhandel zu adressieren.

Gründer*in der Woche: SpeakerMatching.com – Disruption auf der Bühne

Die Eventbranche wächst, doch die Suche nach den passenden Köpfen für die Bühne gleicht oft noch einem analogen Kraftakt. Mit der Plattform SpeakerMatching.com will eine erfahrene Seriengründerin den Spieß nun umdrehen. Es ist ein klassisches Plattform-Play ohne die üblichen Vermittlungsprovisionen – doch kann sich das Modell gegen etablierte Branchengrößen durchsetzen? Wir haben die Gründerin Henriette Hochstein-Frädrich befragt.

Hinter SpeakerMatching.com, im November 2025 als B2B-Marktplatz gelauncht, steht Henriette Hochstein-Frädrich. Sie kennt den Schmerz der Branche nicht nur vom Hörensagen. „Ich kenne den Markt nicht nur als Plattformunternehmerin, sondern auch aus zwei weiteren sehr praktischen Perspektiven: Seit vielen Jahren stehe ich selbst als Speakerin und Moderatorin auf Bühnen, und zugleich habe ich eigene Eventformate und Veranstaltungsreihen im Bereich modernes Female Empowerment konzipiert und umgesetzt“, erinnert sich die Gründerin.

„Gerade als Veranstalterin wurde mir immer wieder bewusst, wie zeitaufwendig, intransparent und teilweise zufallsgetrieben die Suche nach passenden Rednerinnen sein kann“, bringt sie das Kernproblem auf den Punkt. Gleichzeitig habe sie beobachtet, wie sich der Markt zunehmend professionalisiere: „Es gibt mehr Expertinnen, mehr Themen, mehr Formate, aber bislang keine wirklich zeitgemäße digitale Infrastruktur, die Angebot und Nachfrage effizient zusammenführt.“

Dass sie diese Infrastruktur bauen kann, hat sie in der Vergangenheit bewiesen: 2009 gründete sie Pharmatching.com, baute es zur Branchengröße auf und verkaufte es 2017. „Aus meinen früheren Plattformgründungen habe ich vor allem drei zentrale Lektionen mitgenommen: Erfolgreiche Marktplätze lösen ein echtes, konkretes Problem. Vertrauen und Qualität sind im B2B-Umfeld entscheidend. Und nicht zuletzt spielt Timing eine größere Rolle, als viele denken“, betont Hochstein-Frädrich.

Rollentausch statt Kaltakquise

Das Timing sei deshalb ideal, weil Veranstaltende heute Plattformlogiken und Self-Service-Modelle erwarten, wie sie sie aus anderen B2B-Märkten längst kennen. Der Kern von SpeakerMatching.com liegt in der Umkehrung des klassischen Buchungsprozesses. Veranstaltende formulieren ihr Gesuch kostenfrei auf der Plattform, woraufhin sich Speaker*innen direkt bewerben können. Das Start-up finanziert sich stattdessen über Abonnements für die Rednerinnen.

„Uns war von Anfang an wichtig, ein sehr niedrigschwelliges und zugleich faires Preismodell für Speaker*innen zu schaffen“, rechnet die Geschäftsführerin vor. Die monatlichen Mitgliedschaften liegen zwischen rund 59 und 89 Euro. „Wenn über die Plattform ein einzelner Auftrag im mittleren vierstelligen Bereich zustande kommt, hat sich die Investition für viele Redner*innen bereits mehrfach amortisiert.“ Sie stellt aber auch klar: „SpeakerMatching.com ist ein Marktplatz, kein Management- oder Vermittlungsvertrag.“

Doch wie verhindert man eine Flut an unpassenden Bewerbungen? „Die Sorge vor einer unüberschaubaren Bewerbungsflut ist absolut nachvollziehbar, gerade bei offenen Plattformmodellen“, räumt die Gründerin ein. Da Veranstaltende jedoch Parameter wie Budget, Zielgruppe oder Sprache sehr konkret vorgeben, entstehe eine starke Vorfilterung. „Unsere bisherigen Erfahrungen aus den ersten Monaten zeigen sehr deutlich: Unpassende ‚Blindbewerbungen‘ sind die absolute Ausnahme“, versichert Hochstein-Frädrich. Zwar sollen perspektivisch KI-basierte Funktionen eine stärkere Rolle spielen, doch die Vision bleibt menschlich: „Unser Ziel ist daher kein vollständig automatisiertes ‚Black-Box-Matching‘, sondern eine intelligente Plattform, die Entscheidungsprozesse vereinfacht und die Qualität der Interaktionen erhöht.“

Um das Problem des Bypassings – also den Abschluss an der Plattform vorbei – zu umgehen, werden Event-Gesuche zunächst anonymisiert veröffentlicht. „Erst wenn sie passende Bewerbungen erhalten und aktiv in den Austausch gehen möchten, geben sie ihre Identität preis“, erklärt die Gründerin den Prozess. „Wenn Speaker*innen über SpeakerMatching.com kontinuierlich relevante Anfragen erhalten und Veranstaltende effizient passende Expertinnen finden, entsteht eine stabile Win-Win-Dynamik. Genau darauf ist das Modell ausgelegt.“

Markt, Wettbewerb und organisches Wachstum

Der Markt wächst kontinuierlich, wird aber von großen Redneragenturen wie Speakers Excellence oder Premium Speakers dominiert. Diese arbeiten stark kuratiert und rufen oft hohe Vermittlungsprovisionen auf. Um in diesem zweiseitigen Markt das klassische Henne-Ei-Problem zu überwinden, verzichtet die Plattform auf der Veranstaltendenseite auf Gebühren.

Finanziert ist das Vorhaben bisher weitgehend aus eigener Kraft. „Aus meinen früheren Gründungen weiß ich, wie wichtig es gerade in der frühen Phase eines zweiseitigen Marktplatzes ist, Produkt, Zielgruppe und Marktmechanik zunächst sehr präzise zu verstehen und organisch zu entwickeln“, lautet ihr Credo. „Plattformmodelle brauchen Zeit, Vertrauen und kritische Masse, das lässt sich nicht ausschließlich mit Kapital ‚beschleunigen‘, sondern vor allem durch konsequenten Nutzen für beide Marktseiten“.

Dabei grenzt sie sich bewusst von stark kuratierten Agenturen ab. Der Mix aus etablierten Persönlichkeiten und neuen Stimmen sei genau das, was der Markt heute suche. Viele Unternehmen wünschen sich heute bewusst mehr Vielfalt auf ihren Bühnen. „Dabei verstehen wir Diversität nicht nur im klassischen demografischen Sinn, sondern auch als Vielfalt an Perspektiven, Erfahrungen und Denkweisen“, so Hochstein-Frädrich.

Den Vorstoß in Richtung Full-Service-Agenturen samt Ausfallversicherungen bremst sie indes ab. „Im Moment konzentrieren wir uns bewusst darauf, das Matching selbst so gut wie möglich zu machen. Alles Weitere kann – zumindest vorerst – auch von anderen Playern im Ökosystem übernommen werden.“

Fazit

Das Speaker-Business ist traditionell ein echtes People Business. Bei Keynotes für teils fünfstellige Honorare verlassen sich viele Großkund*innen gern auf die persönliche Beratung einer Agentur, die im Krankheitsfall sofort für Ersatz sorgt. Diesen Full-Service kann ein Self-Service-Marktplatz aktuell nur schwer vollumfänglich abbilden.

Dennoch ist SpeakerMatching.com ein mutiger und zeitgemäßer Angriff auf die verkrusteten und provisionsgetriebenen Strukturen der Eventbranche. Gelingt es, rasch eine kritische Masse an hochwertigen Event-Gesuchen zu generieren, hat die Plattform das Potenzial, Angebot und Nachfrage künftig deutlich schneller zusammenzubringen.

Münchner Start-up Isar Aerospace bricht Testflug der „Spectrum“-Rakete aus Sicherheitsgründen ab

Der zweite Testflug der „Spectrum“-Trägerrakete des Münchner Raumfahrtunternehmens Isar Aerospace musste kurz vor der Triebwerkszündung gestoppt werden.

Ursache war nach Unternehmensangaben ein unbefugtes Boot, das in die maritime Sicherheitszone eingedrungen war. Bis das Areal geräumt werden konnte, verstrich das enge Startfenster zwischen 21:00 und 21:15 Uhr. Die Rakete blieb unbeschadet auf der Startrampe.

Sicherheitsmechanismus statt Fehlschlag

In der Raumfahrtbranche wird ein solcher Abbruch (ein sogenannter Scrub) nicht als technologischer Rückschlag gewertet, sondern als Beleg für greifende Sicherheitsmechanismen. Ein erheblicher Unterschied besteht zu einem tatsächlichen Fehlstart, bei dem Hardware verloren geht – wie es beim Erstflug der „Spectrum“ am 30. März 2025 geschah, als die Rakete nach knapp 30 Sekunden wegen eines Ausfalls der Lageregelung ins Meer stürzte.

Da die Rakete dieses Mal keinen technischen Defekt erlitt, werten die Ingenieure den abgebrochenen Countdown als erfolgreichen Härtetest der Bodenanlagen und der automatisierten Betankungsprozesse. Das Team um CEO Daniel Metzler hatte im Vorfeld betont, dass das primäre Ziel der Mission „Onward and Upward“ darin bestehe, kritische Systeme unter operativen Bedingungen zu validieren. Die nun gesammelten Daten fließen direkt in die Vorbereitung des nächsten Versuchs ein.

Die komplexe Logistik eines neuen Startfensters

Wann die „Spectrum“ erneut betankt wird, hängt von einem mehrstufigen Abstimmungsprozess ab. Nach der Sicherung der Rakete muss Isar Aerospace bei den norwegischen Behörden neue Sperrzonen beantragen. Damit Fischer, Frachtschiffe und Fluggesellschaften ihre Routen rechtzeitig anpassen können, müssen offizielle Warnungen für die Schifffahrt (NOTMAR) und den Luftraum (NOTAM) mit entsprechendem Vorlauf herausgegeben werden. Erst wenn diese bürokratischen Hürden genommen sind und Parameter wie das Wetter am Polarkreis übereinstimmen, kann ein neuer Countdown für die Nutzlast – darunter universitäre Kleinsatelliten der TU Berlin, der TU Wien sowie der norwegische FramSat-1 – beginnen.

Warum Andøya? Der strategische Vorteil im hohen Norden

Dass das Münchner Start-up diese logistischen Herausforderungen im hohen Norden auf sich nimmt, anstatt etwa den etablierten europäischen Weltraumbahnhof Kourou in Südamerika zu nutzen, hat strategische und physikalische Gründe.

Die Hauptkunden von Isar Aerospace betreiben kleine Erdbeobachtungssatelliten, die bevorzugt über die Pole fliegen, um die Erdoberfläche lückenlos zu erfassen. Von Andøya aus kann die Rakete auf direktem Weg sicher über das offene Europäische Nordmeer in diesen polaren Orbit starten, ohne Treibstoff für aufwendige Kurskorrekturen zu verbrauchen. Zudem spart der Transport der in Ottobrunn gefertigten Bauteile per LKW und Fähre nach Norwegen wertvolle Zeit und Kosten im Vergleich zu einer Verschiffung nach Französisch-Guayana.

Für Europa bleibt der anstehende Flug der „Spectrum“ ein wichtiges Puzzleteil auf dem Weg zu einem wettbewerbsfähigen, kommerziellen Zugang zum All. Sobald die Sperrzonen vor der norwegischen Küste neu eingerichtet sind, wird sich zeigen, ob das Münchner Unternehmen diese Lücke schließen kann.

Vom Solinger Start-up zum globalen Einhorn: Wie Dash0 die Observability-Giganten dekonstruiert

Das 2023 gegründete KI-Start-up Dash0 hat im März 2026 mit einer 110-Millionen-Dollar-Runde die magische Milliardenbewertung geknackt. Die Vision: Die Systemüberwachung von Software durch offene Standards, radikal faire Preismodelle und pragmatische KI zu revolutionieren. Doch der Frontalangriff auf US-Goliaths wie Datadog birgt strategische Risiken.

In der modernen Softwareentwicklung ertrinken IT-Teams in einer Flut aus Warnmeldungen, Logs und Metriken. Klassische Überwachungs-Tools (Observability) sind oft teuer, komplex und sperren Kunden in geschlossene Daten-Ökosysteme ein. Genau dieses Problem adressiert Dash0 – und hat damit in Rekordzeit Investoren und namhafte Kunden überzeugt. „Systemüberwachung ist heute kaputt: Sie ist zu laut, zu teuer und zu komplex“, bringt es Dash0-CEO und Mitgründer Mirko Novakovic auf den Punkt.

Die Gründer und der rasante Aufstieg zum Einhorn

Hinter Dash0 steht ein Quintett erfahrener Tech-Veteranen. Besonders Mirko Novakovic ist in der B2B-Szene ein Schwergewicht: 2020 verkaufte er sein vorheriges Start-up Instana für rund 500 Millionen US-Dollar an IBM. Dieser „Repeat Founder“-Status erklärt das enorme Vertrauen der Geldgeber.

Die Historie von Dash0 liest sich wie ein Start-up-Märchen im Zeitraffer: Nach der Gründung 2023 im nordrhein-westfälischen Solingen folgte Ende 2024 eine 9,5-Millionen-Dollar-Seed-Runde parallel zum Produktlaunch. Ein Jahr später sammelte das Team 35 Millionen Dollar ein.

Der Ritterschlag folgte nun im März 2026: Mit einer von Balderton Capital angeführten Series-B-Runde über 110 Millionen Dollar steigt Dash0 in den Kreis der Unicorns auf. Diesen Meilenstein verknüpft das Team mit einer klaren Kampfansage: „Mit den 110 Millionen Dollar, die wir heute bekannt geben, bringen wir autonome Abläufe zu jedem Entwicklerteam der Welt – noch bevor unsere Wettbewerber überhaupt begreifen, was mit ihnen geschieht.“

Das Produkt: Ein Frontalangriff auf die Industrie-Norm

Ein Blick unter die Haube zeigt, warum die Plattform so schnell wächst. Das Start-up dekonstruiert gezielt die Schwachstellen der etablierten Milliardenkonzerne:

- Das Ende des „Vendor Lock-ins“: Dash0 basiert vollständig auf offenen CNCF-Standards (OpenTelemetry). Als Abfragesprache wird nativ PromQL genutzt, für Dashboards kommt das quelloffene Perses zum Einsatz. Das bedeutet für Technik-Entscheider: Würde Dash0 die Preise anheben, könnten sie ihre gesamten Dashboards und Alarme einfach mitnehmen und woanders hosten.

- Radikales Pricing: Branchenriesen rechnen oft nach Datenvolumen (Gigabyte) oder Nutzerlizenzen ab, was bei wachsenden Systemen zu explodierenden Budgets führt. Dash0 rechnet rein nach der Anzahl der gesendeten Telemetrie-Datenpunkte ab. Unternehmen können unlimitiert Metadaten anhängen und unbegrenzt viele Entwickler auf das System lassen, ohne dass verdeckte Kosten anfallen.

- Developer Experience (DX): Dash0 positioniert sich als Tool „von Ingenieuren für Ingenieure“. Die Plattform lässt sich für maximale Geschwindigkeit komplett per Tastatur steuern, und Konfigurationen können nahtlos als Code (Configuration as Code) in bestehende Entwicklungs-Pipelines integriert werden.