Aktuelle Events

Hamburger Telemedizin- und KI-Start-up TCC sichert sich 20 Mio. Euro Wachstumskapital

Das 2020 von Prof. Dr. Christian Storm und David Barg gegründete und 2022 gestartete TCC hat sich auf die Fernbetreuung von Intensivpatient*innen spezialisiert.

Gegründet wurde die TCC GmbH 2020 von Prof. Dr. Christian Storm und David Barg. Beide wissen aus eigener, langjähriger Erfahrung, wo die Möglichkeiten der Digitalisierung in der kritischen Infrastruktur von Krankenhäusern liegen: Christian Storm ist habilitierter Intensivmediziner an der Berliner Charité. David Barg ist als ausgebildeter Gesundheitspfleger und studierter Betriebswirt bestens mit dem Klinikalltag vertraut und bringt zudem bereits Erfahrung aus der Managementtätigkeit eines internationalen Gesundheitsdienstleisters (Falck) sowie eines Digital-Unternehmens (MOIA / Volkswagen) mit.

Jetzt hat das Hamburger Start-up erfolgreich seine Series A-Finanzierungsrunde abgeschlossen. In dieser Runde konnte das Unternehmen 20 Millionen Euro Wachstumskapital vom Reeder und Logistikunternehmer Captain Thomas Pötzsch einwerben. Neben der Bereitstellung von Kapital wird Thomas Pötzsch auch mit persönlichem Engagement das Wachstum und die Weiterentwicklung der innovativen Technologien von TCC maßgeblich unterstützen. Für die Ziele der Krankenhausreform - Förderung von Digitalisierung und die ambulante Versorgung - bietet TCC mit seiner Tele-intensivmedizinischen Versorgung eine ideale Lösung für eine ortsunabhängige und effiziente Patient*innenversorgung.

TCC ist 2022 im Bereich der digitalen Fernbetreuung von Intensivstationen gestartet und spezialisiert sich aktuell auf die Entwicklung und Zulassung von KI-Algorithmen, die auf Hochfrequenz-Vitaldaten basieren. Mit Echtzeit-Dashboards zur Entscheidungsunterstützung sowie einer digitalen, sektoren- und fächerübergreifenden Vernetzung von Krankenhäusern und Gesundheitseinrichtungen ebnet TCC damit den Weg für die Zukunft des Gesundheitswesens. „Mit dieser erfolgreichen Finanzierungsrunde sind wir in der Lage, unser erfolgreiches Algorithmen-Entwicklungsprogramm auf dem Weg zum holistischen digitalen Zwilling voranzutreiben“, erklärt Prof. Dr. Christian Storm, CEO und Mitgründer von TCC.

Mit seinem Telehealth-Service bietet TCC digitale Intensivmedizin mit hoher fachlicher Expertise aus der Ferne an. Mehr als zehn ausgebildete Intensivmediziner*innen entlasten von den Standorten Hamburg und Berlin aus zahlreiche Krankenhäuser mit 24/7-Unterstützung durch Telehealth-Services sowie Risikoanalyse und Prävention. Zu den Kund*innen von TCC zählen unter anderem das Unfallkrankenhaus Berlin, das Krankenhaus Region Hannover (KRH) mit sechs Kliniken, das Universitätsklinikum Schleswig-Holstein (UKSH) in Lübeck sowie Netcare Südafrika, einem Klinikverbund aus 44 Krankenhäusern mit 9.000 Betten (davon 1.000 Intensivbetten). Insgesamt betreut TCC mehr als 3.000 Betten weltweit, davon 300 in Deutschland. Neben der proaktiven telemedizinischen Betreuung von Intensivstationen, wird TCC verstärkt in die Digitalisierung und Optimierung von Krankenhausprozessen investieren. Das langfristige Ziel des Unternehmens ist es, das Gesundheitssystem zu entlasten, die verbliebenen Ressourcen optimal einzusetzen und die Behandlungsqualität zu verbessern oder zumindest zu erhalten.

„Mit dem frischen Kapital können wir unseren Wachstumskurs weiter dynamisch fortführen und substanzielle neue Märkte erschließen“, fügt David Barg, CEO und Mitgründer von TCC, hinzu.

„Hier wird TCC mit seinen KI-gesteuerten Überwachungssystemen den Menschen Mehrwert und Sicherheit bieten. Gleichermaßen lassen sich die demographischen Lücken in Krankenhäusern schließen sowie mit dem telemedizinischen Ansatz Ressourcen optimieren. Die Idee sowie der Entwicklungsstand von TCC haben uns so überzeugt, dass wir mit unserem Engagement TCC in den nächsten Jahren begleiten werden", erklärt Captain Thomas Pötzsch.

Diese Artikel könnten Sie auch interessieren:

Produktivität statt Überstunden: Wie Echtzeitdaten das Finanzwesen von morgen steuern

Das KI-gestützte Fintech Embat beendet das Excel-Chaos im Treasury und macht Finanzteams mit Echtzeitdaten fit für die Zukunft.

Berlin, 28. April 2026 – Es ist ein bekanntes Bild in den Finanz- und Treasury-Abteilungen des deutschen Mittelstands: Wenn der Monatsabschluss naht oder Ad-hoc-Berichte für die Geschäftsführung benötigt werden, bleiben die Schreibtischlampen bis spät in die Nacht an. Die manuelle Zusammenführung von Daten aus unterschiedlichen Bankportalen und historisch gewachsenen Excel-Listen kostet nicht nur Nerven, sondern vor allem wertvolle Zeit.

Das schnell wachsende Fintech Embat tritt an, um genau diesen Engpass aufzulösen. André Reimers, Head of DACH, treibt diese Mission im deutschsprachigen Raum als Gesicht des Unternehmens voran. Seine Kernüberzeugung: Wer heute noch regelmäßig Überstunden machen muss, um finanzielle Transparenz zu schaffen, leidet nicht unter mangelnder Einsatzbereitschaft – er leidet unter einem strukturellen Datenproblem.

Beeindruckendes Wachstum durch das Lösen echter Pain Points

Dass der Schmerz in den Finanzabteilungen groß und der Bedarf an modernen Lösungen riesig ist, belegen die Zahlen, mit denen Embat den europäischen Markt aufrollt. Mit einem starken Kundenwachstum im deutschen Markt von über 250 Prozent im vergangenen Jahr und mittlerweile mehr als 400 mittelständischen und großen Unternehmenskunden weltweit hat sich das Fintech als fester Player etabliert. Das stetig wachsende Transaktionsvolumen von 250 Millionen Euro zeigt deutlich: Der Wechsel von fehleranfälligen Tabellen zu automatisierten Cloud-Lösungen ist in vollem Gange.

Der Weg aus der Excel-Falle

Mit seiner Technologie nimmt Embat den Kampf gegen ineffiziente Prozesse im Treasury auf. Anstatt hochqualifizierte Mitarbeiter mit repetitiver Datenpflege zu binden, automatisiert das System die Konsolidierung aller relevanten Finanzdaten.

„Die Erwartungshaltung, dass komplexe Finanzanalysen zwingend mit langen Abenden im Büro einhergehen müssen, ist schlichtweg nicht mehr zeitgemäß“, erklärt André Reimers. „Wenn Cashflow, Liquidität und Runways per Knopfdruck in Echtzeit abrufbar sind, ändert sich die gesamte Arbeitsdynamik. Finanzteams können aus dem reaktiven Modus heraustreten und sich auf die strategische Steuerung des Unternehmens konzentrieren.“

Hohe Innovationskraft trifft auf lokales DACH-Verständnis

Embat profitiert von einer enormen Innovationsgeschwindigkeit und Agilität, auf der die starke technologische Basis des Unternehmens beruht. Wie diese passgenau auf die spezifischen Bedürfnisse des deutschen Marktes übersetzt wird und für eine hohe lokale Marktpräsenz sorgt, zeigt André Reimers an den Standorten in München und Berlin.

Von diesen beiden Standorten aus steuert André Reimers das DACH-Geschäft und stellt das tiefe Verständnis für die komplexen Strukturen und hohen Sicherheitsbedürfnisse des deutschen Mittelstands sicher. Das Team zeigt dabei, wie moderne, dezentrale Zusammenarbeit erfolgreich funktioniert. Das Vertrauen der stetig wachsenden deutschen Kundenbasis fußt dabei auf dieser geballten lokalen Expertise gepaart mit der unerschütterlichen Zuverlässigkeit der Systeme.

Führen durch Resultate, nicht durch Anwesenheit

Die Botschaft an die Finanzwelt ist klar: Moderne Führung, hohe Produktivität und Skalierbarkeit erfordern keine starren Kontrollmechanismen oder endlosen Arbeitstage. Sie erfordern radikale Datentransparenz und die richtigen digitalen Werkzeuge. Wenn die Daten in Echtzeit fließen, sinkt die Fehlerquote, die Entscheidungsgeschwindigkeit steigt – und die systembedingten Überstunden im Treasury gehören endgültig der Vergangenheit an.

Über Embat:

Embat ist ein KI-gestütztes FinTech mit Schwerpunkt auf Treasury-Management, das es mittelständischen Unternehmen und Großkonzernen ermöglicht, ihre Finanzprozesse in Echtzeit zu zentralisieren. Gegründet von Antonio Berga und Carlos Serrano – ehemaligen J.P. Morgan-Managern mit umfassender Erfahrung im Corporate Banking – sowie Tomás Gil, dem ehemaligen CTO von Fintonic, entstand die Plattform mit der Mission, die Finanzabteilung zu digitalisieren. Die klare Prämisse dabei: Technologie von Finanzexperten für Finanzexperten.

Durch seine hybride Konnektivität lässt sich Embat in über 15.000 Banken und führende ERP-Systeme integrieren und beseitigt so jegliche Datenfragmentierung. Das wichtigste Alleinstellungsmerkmal ist TellMe, ein „Agentic Treasury Analyst“ (autonomer KI-Analyst), der Cashflow-Muster erkennt, komplexe Kontenabstimmungen automatisiert und strategische Entscheidungen zur Optimierung der Liquidität vorschlägt.

Mit Niederlassungen in Madrid, London, Berlin und München definiert Embat die Zukunft des Corporate Finance neu.

DeepTech trifft Food-Safety: 2,6 Mio. Euro für NanoStruct

Food-Safety-Revolution? NanoStruct weist Bakterien in Stunden statt Tagen nach & holt 2,6 Mio. € Seed-Kapital. Wir machen den DeepTech-Check.

Frische Lebensmittel sind ein Wettlauf gegen die Zeit. Bislang dauert der Nachweis von gefährlichen Erregern wie Salmonellen oder Listerien oft mehrere Tage – ein erhebliches Risiko für verderbliche Waren. Das Würzburger Uni-Spin-off NanoStruct will diesen Engpass mit einer neuen Analyseplattform beheben und hat dafür nun eine Seed-Finanzierung in Höhe von 2,6 Millionen Euro eingesammelt. Doch wie tragfähig ist das DeepTech-Modell in der konservativen Lebensmittelindustrie wirklich?

Das Würzburger Startup NanoStruct tritt an, um die mikrobiologische Lebensmittelanalyse von Grund auf zu beschleunigen. Durch die Kombination von optischer Messtechnik, Nanotechnologie, Biotechnologie und maschineller Datenauswertung soll der Nachweis pathogener Bakterien von mehreren Tagen auf wenige Stunden schrumpfen.

Die aktuelle Seed-Runde über 2,6 Millionen Euro bringt namhafte Investoren an Bord: Angeführt wird die Runde vom High-Tech Gründerfonds (HTGF), Bayern Kapital und dem AUXXO Female Catalyst Fund. Ergänzt wird das Kapital durch drei Business Angels aus dem Netzwerk von BayStartUP.

Gold-Antennen statt Petrischalen

Im Kern basiert das Verfahren von NanoStruct auf der sogenannten Surface-enhanced Raman Spectroscopy (SERS). Die Sensoren nutzen dabei ultrapräzise Gold-Nanoantennen, um selbst geringste Mengen von Bakterien verlässlich zu identifizieren.

Interessant ist hierbei ein Blick auf die technologischen Versprechungen: Während das Startup in jüngsten Einreichungen für Branchenpreise (wie den AMA Innovationspreis 2025) noch explizit von einem "Drei-Minuten-Bakterientest" sprach, stapelt die aktuelle Pressemitteilung etwas tiefer und verspricht eine Verkürzung auf "wenige Stunden". Dies ist ein bekanntes Phänomen in der Bio-Sensorik: Während die reine optische Messung im Labor oft nur Minuten dauert, nimmt die komplexe Probenaufbereitung aus realen, unsauberen Lebensmittelmatrizen in der Praxis weiterhin Stunden in Anspruch. Dennoch: Ein Testergebnis noch am selben Tag ("Same-Day-Detection") bedeutet für Produzenten einen gewaltigen Fortschritt.

Aus dem Uni-Labor zum Millionen-Funding

Die Wurzeln des Unternehmens liegen in der Julius-Maximilians-Universität Würzburg, aus der NanoStruct 2021 ausgegründet wurde. Das Gründerteam vereint dabei interdisziplinäre Kompetenzen:

Dr. Henriette Maaß (CEO) verantwortet die Unternehmensstrategie. Sie führte das Startup bereits erfolgreich durch das EU-Förderprogramm "Women TechEU", welches von Frauen geführte Hochtechnologie-Startups unterstützt.

Enno Schatz (CTO) bringt als Experte für Nano-Optik und Sensorik das tiefe technologische Know-how ein.

Kai Leibfried (CFO) steuert die Finanzierung, Geschäftsentwicklung und die kaufmännischen Prozesse.

Der Weg zur Seed-Runde wurde unter anderem durch BayStartUP geebnet: Bereits 2021 gewann das Team das Finale des Businessplan-Wettbewerbs Nordbayern. Aus diesen ersten Berührungspunkten entwickelte sich laut Carsten Rudolph, Geschäftsführer von BayStartUP, das heutige Investorenkonsortium.

Markt, Geschäftsmodell und Wettbewerb – Eine Einordnung

Mit dem frischen Kapital plant NanoStruct nun die Industrialisierung der Technologie, erste Pilotprojekte mit Kunden sowie den Ausbau des Vertriebs. Langfristig sehen die Investoren das Potenzial der Plattform-Technologie auch in weiteren kritischen Bereichen wie der Wasserversorgung, der Medizintechnik oder der Diagnostik.

StartingUp ordnet das Vorhaben wie folgt ein:

Der Markt (Pro): Das wirtschaftliche Potenzial ist enorm. Erreger-Tests am selben Tag reduzieren Lebensmittelverschwendung drastisch, da verderbliche Waren nicht mehr tagelang in Quarantäne-Lagern auf ihre Freigabe warten müssen. Zudem lassen sich millionenschwere, rufschädigende Rückrufaktionen frühzeitig abwenden.

Markteintrittsbarrieren (Contra): Die Lebensmittelindustrie ist hochgradig konservativ und streng reguliert. Ein neues Testverfahren muss nicht nur schneller, sondern zu 100 Prozent fehlerfrei arbeiten. "False-Positives" (falscher Alarm) kosten die Industrie Geld, "False-Negatives" gefährden Menschenleben. Das Vertrauen der Industrie in etablierte Standardverfahren ist historisch gewachsen und tief verankert.

Hardware-Skalierung: Im Gegensatz zu reinen Software-Geschäftsmodellen muss NanoStruct die SERS-Sensoren auf Nanotechnologie-Basis wirtschaftlich in Masse herstellbar machen. Die Skalierung von DeepTech-Hardware verschlingt erfahrungsgemäß viel Zeit und hohe Folgeinvestitionen.

Der Wettbewerb: NanoStruct tritt gegen milliardenschwere Diagnostik-Konzerne und etablierte Verfahren wie PCR-Tests an. Der entscheidende USP von NanoStruct wird es sein, zu beweisen, dass die Sensoren in der rauen industriellen Praxis tatsächlich so robust, günstig und verlässlich sind, dass sie die immensen Wechselkosten für Großkunden rechtfertigen.

Fazit

NanoStruct bringt technologisch exzellente Voraussetzungen mit und hat sich mit dem HTGF, Bayern Kapital und AUXXO sehr starke, gut vernetzte Partner gesichert. Gelingt es dem Team nun, die Technologie aus dem Würzburger Labor erfolgreich in die industrielle Realität der Lebensmittelproduktion zu übertragen, könnte das Startup tatsächlich einen neuen Goldstandard in der mikrobiologischen Qualitätskontrolle etablieren. Die wichtigste Phase – der Beweis am Kunden – beginnt jetzt.

Primogene: 4,1 Mio. Euro für den Muttermilch-Code – Deep-Tech-Innovation oder riskantes Unterfangen?

Das Leipziger BioTech-Start-up Primogene hat eine Seed-Finanzierung in Höhe von 4,1 Mio. Euro eingesammelt, um komplexe bioaktive Moleküle im industriellen Maßstab auf den Markt zu bringen.

Während die Unternehmenskommunikation den Durchbruch einer neuen Plattformtechnologie feiert, zeigt ein genauerer Blick auf den globalen Markt für humane Milcholigosaccharide (HMOs) ein Haifischbecken voller multinationaler Konzerne. Eine kritische Analyse des Geschäftsmodells, der Gründer*innen und des Wettbewerbs.

DeepTech Made in Leipzig

Hinter Primogene stehen Dr.-Ing. Reza Mahour (CEO), Valerian Grote und Linda Karger (COO), die das Unternehmen 2023 in Leipzig gründeten. Die Zusammensetzung des Teams vereint technologische und wissenschaftliche Expertise, um die ehrgeizige Vision einer industriellen Enzym-Produktion umzusetzen. Die aktuelle, 4,1 Millionen Euro starke Seed-Runde wird vom High-Tech Gründerfonds (HTGF) angeführt. Zum Investoren-Konsortium gehören außerdem der Technologiegründerfonds Sachsen (TGFS), better ventures, die Sächsische Beteiligungsgesellschaft (SBG), die Golzern Holding GmbH, die FS Life Science Investment GmbH sowie Dr. Marc Struhalla, Gründer und CEO der c-LEcta GmbH. Der Kapitaleinsatz ist klar definiert: Die neuen Mittel fließen in den Ausbau des IP-Portfolios, die Erweiterung der Produktionskapazitäten in Leipzig und in strategische Partnerschaften.

Das Modell im Stresstest: Die Kostenfalle der Enzyme

Primogene hat eine enzymatische Plattformtechnologie entwickelt, um Inhaltsstoffe zu produzieren, die identisch zu natürlichen Molekülen sind – nachhaltig und kosteneffizient. Im Zentrum stehen dabei komplexe humane Milcholigosaccharide (HMOs) wie Disialyllacto-N-Tetraose (DSLNT) und Difucosyllacto-N-Tetraose I (LNDFH I). Laut Primogene verursachen etablierte fermentative Herstellungsverfahren erhebliche Kosten und stoßen bei der Produktion derartiger hochkomplexer Moleküle an ihre Grenzen.

Der Lackmustest: Die Prämisse, dass enzymatische Verfahren in der Massenproduktion überlegen sind, birgt in der Praxis massive Hürden. Die Entwicklung und wirtschaftliche Produktion der benötigten Enzyme selbst ist extrem kapitalintensiv. Dass das Start-up den gesamten Prozess – von der Enzymentwicklung über die Produktion und Biotransformation bis zur Aufreinigung – komplett am eigenen Unternehmensstandort in Leipzig abbilden will, ist ein ambitionierter, aber riskanter Schritt. Der Aufbau eigener Produktionsanlagen für komplexe BioTech-Prozesse führt oft zu einer enorm hohen Kapitalverbrennungsrate (Burn Rate).

Erste kommerzielle Meilensteine dämpfen dieses Risiko jedoch: Erste Inhaltsstoffe für Kosmetikprodukte wurden mit Kooperationspartnern entwickelt und sind bereits kommerziell erhältlich. Auch pharmazeutische Rohstoffe befinden sich aktuell im Test bei Kund*innen. Zudem erforscht das Unternehmen in Zusammenarbeit mit dem Fraunhofer-Institut für Zelltherapie und Immunologie (IZI) in Leipzig das Potenzial seiner Inhaltsstoffe zur Prävention von Infektionskrankheiten.

Im Haifischbecken: Auf Kollisionskurs mit den Lebensmittel-Riesen

Der Zielmarkt ist hochattraktiv: Der globale HMO-Markt wächst jährlich um etwa 18 bis 20 Prozent, und über 65 Prozent der im Jahr 2023 neu eingeführten Säuglingsnahrungsprodukte enthielten mindestens ein HMO. Neben der Säuglingsernährung bedient Primogene auch Märkte wie die Darmgesundheit bei Erwachsenen, die Gedächtnisverbesserung im Alter sowie funktionale Inhaltsstoffe für Körperpflege und pharmazeutische Rohstoffe.

Das Leipziger Team trifft in der Nahrungsmittelindustrie jedoch auf einen extrem konsolidierten Markt, der von Milliarden-Konzernen dominiert wird. Einer der größten B2B-Zulieferer für Säuglingsnahrung weltweit ist DSM-Firmenich (mit der übernommenen Sparte Glycom), der den Markt durch gigantische Größenvorteile (Economies of Scale) in der Fermentation beherrscht. Auch Chr. Hansen (Jennewein), ein Pionier in der mikrobiellen HMO-Synthese, stellt mit seiner extrem tiefen Integration bei Lebensmittelriesen einen massiven Konkurrenten dar. Auf der Abnehmerseite agieren Endkonsument*innen-Giganten und Branchenführer wie Nestlé und Abbott, bei denen für einen neuen Zulieferer von Inhaltsstoffen extrem hohe regulatorische und volumenbasierte Hürden bestehen.

Primogenes strategische Nische: Ein Preiskampf bei einfach strukturierten Standard-HMOs gegen die großen Fermentations-Player wäre für ein Start-up kaum zu gewinnen. Primogenes entscheidender Wettbewerbsvorteil liegt jedoch in der Komplexität. Die industrielle Produktion von Molekülen wie DSLNT – das laut klinischen Studien signifikante gesundheitliche Vorteile speziell für Frühgeborene bietet – war bislang schlicht nicht möglich. Wenn Primogene hier durch sein starkes Patentportfolio die technologische Lücke schließt, umgeht das Unternehmen den harten Konkurrenzkampf im Massenmarkt.

Unser Fazit: Hohes Risiko, riesiger Hebel

Primogene ist kein schlankes Software-Projekt, sondern waschechtes DeepTech. Das bedeutet: Hohe regulatorische Hürden, langer Atem in der Forschung und massive Kapitalanforderungen. Die Seed-Finanzierung in Höhe von 4,1 Millionen Euro ist ein starker Vertrauensbeweis erfahrener Investoren, wird für den Anlagenbau und die Skalierung der Leipziger Produktion auf Dauer jedoch kaum ausreichen. Primogene muss nun rasch beweisen, dass die enzymatische Synthese nicht nur technologisch überlegen, sondern auch unter realen industriellen Kostendrücken skalierbar ist. Gelingt dieser Proof of Concept, hält das Start-up den Schlüssel zu einer neuen Generation komplexer, bioaktiver Moleküle in der Hand.

Vom Notfallknopf zum KI-Begleiter: Patronus sammelt 11 Mio. Euro ein

Das 2020 von Ben Staudt und Tim Wagner gegründete Berliner Start-up Patronus sichert sich eine weitere Mio.-Finanzierungsspritze für seinen digitalen (Notruf-)Assistenten im Smartwatch-Format. Doch im stark umkämpften Senior*innen-Tech-Markt reicht ein schickes Design allein nicht mehr aus. Ein Blick hinter die Kulissen von Geschäftsmodell, Historie und wachsendem Wettbewerb.

Die Idee zu Patronus entstand aus einem klassischen Alltagsproblem, das viele Familien kennen: Gründer Ben Staudt erlebte bei seiner eigenen Großmutter, dass der traditionelle, klobige Hausnotrufknopf statt um den Hals zu hängen, lediglich als „Nachttischdekoration“ fungierte. Gemeinsam mit Mitgründer Tim Wagner rief er daraufhin im Jahr 2020 das Unternehmen in Berlin ins Leben. Vor der Veröffentlichung ihres ersten Produkts im Jahr 2021 führte das Team nach eigenen Angaben über tausend Gespräche mit potenziellen Nutzer*innen. Die zentrale Erkenntnis: Die Ablehnung herkömmlicher Notrufsysteme ist weniger technischer Natur, sondern vielmehr ein Problem der Würde und Stigmatisierung.

Mittlerweile ist das Team auf 70 Mitarbeitende angewachsen. Nachdem das Start-up in der Vergangenheit bereits eine beachtliche 27-Millionen-Euro-Runde abschließen konnte, fließen nun weitere 11 Millionen Euro Wachstumskapital in das Unternehmen. Bei dieser Runde wird das Konsortium von 3TS Capital Partners angeführt. Begleitet wird die Finanzierung von Grazia Equity sowie Bestandsinvestoren wie Singular, Burda Principal Investments, Adjacent, NAP und UVC Partners.

Das Produkt: Hohe Akzeptanz trifft auf KI-Visionen

Das Kernprodukt von Patronus ist eine Smartwatch, die sich optisch bewusst von klassischer Medizintechnik abhebt, verschiedene Farben bietet und wie eine herkömmliche Armbanduhr wirkt. Ausgestattet mit einer integrierten SIM-Karte stellt sie im Notfall auf Knopfdruck eine sofortige Verbindung zu einer hauseigenen, mit Fachpersonal besetzten 24/7-Notrufzentrale her.

Der nutzer*innenzentrierte Ansatz zeigt laut Unternehmenszahlen deutliche Wirkung:

- Während klassische Hausnotrufgeräte laut Studien nur von 14 Prozent der Nutzer*innen durchgehend getragen werden.

- Liegt die tägliche Tragequote der Patronus-Uhr bei 85 Prozent.

- Mittlerweile verzeichnet das Start-up 25.000 aktive Kund*innen.

- Die hauseigene Zentrale hat für diese Nutzer*innen bereits mehr als eine halbe Million Notrufe beantwortet.

- Parallel dazu verbindet eine eigens entwickelte App 50.000 Angehörige mit den Senior*innen, um deren Status – wie den Standort oder ob die Uhr getragen wird – im Blick zu behalten.

Das frische Kapital fließt nun in den weiteren Ausbau der Marktführerschaft im mobilen Notrufsegment sowie in einen neuen Produktbereich: einen KI-Begleiter. Dieser soll als digitaler Assistent direkt am Handgelenk über die Patronus Uhr verfügbar sein. Da 12 Prozent der über 75-Jährigen in Deutschland an einem durchschnittlichen Tag kein einziges persönliches Gespräch führen, soll der Assistent dem Gefühl der Einsamkeit in stillen Stunden entgegenwirken.

Geschäftsmodell, Markt & Wettbewerb

So glänzend die Zahlen der Pressemitteilung wirken, verlangt das Geschäftsmodell im dynamischen AgeTech-Sektor eine differenzierte Betrachtung:

Der demografische Rückenwind: Der Bedarf an digitalen Lösungen für ältere Menschen wächst rasant. In Deutschland leben heute 9,6 Millionen Menschen im Alter von über 75 Jahren, in ganz Europa sind es 47,4 Millionen. Gleichzeitig nimmt die Zahl der pflegenden Angehörigen ab. Ein immer größerer Anteil will allein leben. Laut Destatis leben in Deutschland bereits 43 Prozent der Menschen über 75 Jahre allein.

Abo-Modell und Kassen-Abhängigkeit: Patronus refinanziert sich maßgeblich über ein Abo-Modell. Ein wesentlicher Wachstumstreiber ist dabei der deutsche Gesundheitsmarkt: Bei Vorliegen eines Pflegegrads kann die Pflegekasse die monatlichen Nutzungsgebühren (die Software, SIM-Karte und Leitstelle abdecken) stark bezuschussen. Ohne diese staatlichen Subventionen hätten viele Senioren Schwierigkeiten, die fortlaufenden Service-Kosten zu tragen. Diese Abhängigkeit von gesundheitspolitischen Rahmenbedingungen bleibt ein strukturelles Risiko.

Der harte Hardware-Wettbewerb: Patronus positioniert sich als digitaler Marktführer im mobilen Notrufsegment in Deutschland. Doch die Konkurrenz holt auf. Dedizierte Senior*innen-Smartwatches anderer Anbieter*innen bieten ebenfalls moderne Designs, SIM-Karten, Notruf-Sprachverbindungen und teils automatische Sturzerkennungen an. Zudem dringen Tech-Giganten tief in den Markt ein: Apple Watches verfügen längst über präzise Sturzerkennungen und EKG-Funktionen und werden zunehmend von technikaffinen "Best Agern" adaptiert. Der langfristige Burggraben von Patronus muss daher zwingend in der nahtlosen, stark vereinfachten Software-Integration und der menschlichen Notrufzentrale liegen – die Hardware allein ist auf Dauer austauschbar.

Das ethische Dilemma der KI: Einsamkeit unter älteren Menschen ist ein anerkanntes Gesundheitsrisiko, das die kognitive Leistungsfähigkeit beeinflussen, das Demenzrisiko erhöhen und die Lebenserwartung verkürzen kann. Die Lösung von Patronus, diesem Problem mit einem KI-Begleiter zu begegnen, ist innovativ, aber ethisch sensibel. Altersforscher warnen davor, dass "künstliche" Gespräche den Drang nach echten sozialen Interaktionen mindern könnten. Dass Patronus selbst betont, der KI-Begleiter solle menschliche Nähe nicht ersetzen, sondern nur eine Antwort für Stunden bieten, in denen niemand da ist, ist ein wichtiger Disclaimer. Dennoch muss das Unternehmen in der Praxis beweisen, dass die KI im sensiblen Pflegeumfeld echte Empathie simulieren kann, ohne die Nutzer*innen zu verwirren.

Unser Fazit

Patronus zeigt, wie man durch konsequentes User-Centric-Design einen verstaubten Markt aufbricht und stigmatisierte Produkte salonfähig macht. Die neuen 11 Millionen Euro geben dem Start-up den nötigen Spielraum für technologische Innovationen. Um die hohe Bewertung nachhaltig zu rechtfertigen, muss Patronus künftig jedoch beweisen, dass der Vorstoß in die künstliche Intelligenz ethisch sauber umgesetzt wird und man dem zunehmenden Hardware-Preisdruck der Wettbewerber*innen standhalten kann.

Gründer*in der Woche: Vjus.AI – Vom SEO zum GEO

Wie das 2026 von Wolfe Diener gegründete Start-up Vjus.AI den Kampf um die KI-Sichtbarkeit gewinnen will.

Die Ära der klassischen Suchmaschinenoptimierung (SEO) bekommt ernstzunehmende Konkurrenz. Wenn Nutzer*innen heute nach Produkten oder Dienstleistungen suchen, tippen sie ihre Fragen zunehmend in Dialogfenster von Sprachmodellen statt in traditionelle Suchschlitze. Genau an dieser Schnittstelle positioniert sich das neu gestartete Münchner Start-up Vjus.AI. Doch kann eine Software wirklich die „Black Box“ der generativen KI entschlüsseln – und wie nachhaltig ist das Geschäftsmodell?

Hinter der am 1. April 2026 offiziell gelaunchten Plattform steht die AtWize Business Services GmbH mit Sitz in München. Kopf des Unternehmens ist Gründer Wolfe W. Diener, der zuvor bereits in leitenden Positionen als Geschäftsführer und im Vorstand großer Softwarehäuser aktiv war. Mit dem Start von Vjus.AI vollzieht das Unternehmen nun eine strategische Erweiterung in den stark wachsenden Bereich der Answer Engine Optimization (AEO) und Generative Engine Optimization (GEO).

Vom Humankapital zur KI-Sichtbarkeit

Die Historie des Unternehmens ist dabei von einem interessanten Strategiewechsel geprägt. Ursprünglich startete AtWize 2023 mit einem Fokus auf KI-Lösungen gegen den Fachkräftemangel. Diener erklärt die Hintergründe: „Parallel hatte ich schon eine Weile an der Idee arbeitete, Unternehmen zu ermöglichen, ihre in den Ruhestand ausscheidenden Mitarbeiter strukturierter zu managen, um sie bei Bedarf für Projekte oder übergangsweise anzusprechen. Es liegt so viel Humankapital und Erfahrung brach.“ In der aktuellen wirtschaftlichen Phase sei dies jedoch kein Top-Thema gewesen, weshalb man sich zunächst auf die Software-Entwicklung für Dritte konzentriert habe.

Der eigentliche „Aha-Moment“ kam durch die tägliche Arbeit. „Im letzten Jahr haben wir dann immer mehr auch KI-Tools zur Entwicklung eingesetzt und dabei den Bedarf, sogar die Notwendigkeit erkannt, die Sichtbarkeit in KI-Modellen zu messen und zu verbessern“, so Diener. Die Dringlichkeit begründet er mit dem veränderten Nutzer*innenverhalten: „KI-Modelle geben begründete Empfehlungen zur gestellten Frage. Da sucht man nicht weiter, sondern nimmt das Ergebnis wie es ist. Wer da nicht enthalten ist, ist unsichtbar.“

Nutzer*innensimulation: Die reale Perspektive

Vjus.AI setzt auf die Simulation realer Suchanfragen. Während klassische SEO-Tools oft auf APIs zugreifen, misst diese Plattform, wie Marken in Antworten von ChatGPT, Gemini, Grok oder Perplexity tatsächlich erscheinen. Auf die Frage nach der technischen Umsetzung und der Nicht-Deterministik der KI-Modelle antwortet Diener detailliert: „Wenn Sie Ihre Sichtbarkeit bei KI-Suchen wissen wollen, dann sollte diese ja so gemessen werden, wie sie ein normaler Nutzer, der einem KI-Modell eine Frage stellt, einen Prompt eingibt, auch sieht.“ Man müsse also zunächst Prompts definieren, bei denen man gefunden werden wolle – etwa als Münchner Zahnarzt bei der Frage nach dem besten Zahnarzt vor Ort.

„Wir analysieren die Ergebnisse, die von den KI-Modelle auf die Prompts hin geliefert werden“, erklärt Diener weiter. Dabei werden Kennzahlen wie Sichtbarkeit, Ranking und Sentiments (neutrale, positive oder negative Notation) erhoben. Den Vorwurf einer verzerrenden technischen Schicht weist er zurück: „Wir sind insofern keine Zwischenschicht, sondern werten die Daten aus, die viele User auch sehen würden. Die Nicht-Deterministik führt dabei zwar zu kleinen Schwankungen, aber es entsteht insgesamt ja ein Bild über die Zeit.“

Marktchancen und der „Unfair Advantage“

Das Interesse am Markt scheint groß zu sein; bereits vor dem offiziellen Launch konnten erste Kund*innen gewonnen werden. Finanziell steht das Start-up auf eigenen Beinen: „Wir finanzieren uns komplett aus eigenen Mitteln. Und da wir schon Kunden im Entwicklungsbereich haben, konnten wir Vjus.AI früh anwenden und testen“, betont der Gründer. Mit Investor*innen habe man noch nicht gesprochen: „Jetzt erst mal machen, dann reden wir.“

Um sich gegen die großen SEO-Platzhirsche zu behaupten, setzt Diener auf vier spezifische technische Vorteile. Erstens setze man auf eine natürliche Simulation: „Unsere Art des Promptens simuliert wirklich natürliche User. Andere machen das nicht.“ Zweitens komme eine eigene Scraping-Technologie zum Einsatz. Diese erlaube eine besonders detaillierte Analyse der Ergebnisse, auch der „Nebengeräusche“ wie etwa Quellenangaben. Als dritten Punkt nennt der Gründer das analytische Prompting: Vjus.AI unterstützt nicht nur beim Erstellen von Prompts, sondern analysiert auch, wie passend diese für die Sichtbarkeitsmessung sind. Viertens biete das Improver-Modul ein Analyse-Tool, das über die Daten hinweg ermittelt, „was die Haupthebel für das Unternehmen oder die Marke ist, um die Sichtbarkeit bei KI-Suchen zu erhöhen“.

GEO als neues Standard-Tool?

Für die Zukunft sieht Diener eine klare Entwicklung. Zwar werde es in zwei Jahren wahrscheinlich immer noch die klassische Google-Suche geben, doch der Übergang sei bereits fließend, da Google zunehmend KI-Ergebnisse mitliefere. „Die Suche mit KI-Modellen wird aber die gewohnte Praxis werden“, ist sich Diener sicher.

Seine Prognose für die Branche ist deutlich: „Insofern wird SEO eher übergehen in ein GEO. Ein SEO ohne Beachtung der Optimierungen für KI-Modelle macht aus meiner Sicht aber heute schon keinen Sinn mehr.“ Das Ziel für Vjus.AI ist dabei klar gesteckt. Die größte Hürde sei es, für die Nutzer*innen den besten Mehrwert zu generieren: „Darauf liegt unser Fokus und deshalb rennen wir, so schnell wir können.“

Spritgeld für den Start-up-Motor: PR-Stunt oder genialer Dealflow-Generator? Der neue „GründerTank“ von Christopher Obereder im Check

Reisekosten, Tankrechnungen und Bahntickets sind für junge Bootstrapping-Start-ups oft schmerzhafte Posten. Der Münchner Investor und Ex-Silicon-Valley-Macher Christopher Obereder will mit einer neuen privaten Initiative für Start-ups in Deutschland genau hier ansetzen. Ein Gesamtbudget von bis zu 100.000 Euro steht für betriebliche Mobilitätskosten bereit. Doch hinter der pragmatischen Fördermittel-Story verbirgt sich ein überaus cleveres Geschäftsmodell zur Startup-Akquise. Eine Einordnung.

Wer den GründerTank verstehen will, muss zunächst auf seinen Initiator blicken. Christopher Obereder, in der Szene oft schlicht Startup-Chris genannt, ist kein Unbekannter. Bereits 2017 landete er als 26-Jähriger auf der renommierten „Forbes 30 Under 30“-Liste. Im Silicon Valley erarbeitete er sich einen Ruf als Experte für virales Marketing. Mit Exits und Engagements bei Hit-Apps wie Tellonym baute er sich finanzielles Gewicht auf. Durch medienwirksame Formate, wie die von ihm initiierte Bayern 3 Startup Challenge, brachte er das Thema Start-up-Finanzierung einem breiten Publikum nahe. Heute leitet er von Taufkirchen aus die Start-up-Chris Ventures GmbH und investiert gezielt in junge Tech-Unternehmen.

Spritgeld statt Folien-Bingo

Mit dem GründerTank, der von Unicorn AI unterstützt wird, ruft Obereder nun eine konkrete Mobilitätsförderung ins Leben. Der Fokus liegt dabei nicht auf schönen Präsentationen, sondern auf der harten operativen Realität. Unterstützt werden können je nach Einzelfall unter anderem Kraftstoffkosten für geschäftliche Fahrten, ÖPNV-Tickets, Carsharing oder Reisen zu Messen und Investoren.

Obereders Argumentation ist bestechend pragmatisch: „Wir tanken nicht nur Autos. Wir helfen Gründerinnen und Gründern, in Bewegung zu bleiben“, erklärt der Investor. „Viele Programme sprechen über Innovation. Mich interessiert, ob Gründer wirklich unterwegs sind, Kunden treffen, Feedback einsammeln und Momentum aufbauen. [...] Wenn Bewegung im Alltag ein echter Hebel ist, soll sie nicht an ein paar Rechnungen scheitern.“

Erstes gefördertes Start-up dieser Initiative ist Kluuu, eine innovative Lernplattform, die es Studierenden ermöglicht, ihren Lernstoff in interaktive Quizze umzuwandeln. Deren Vertreter Leon Sean Brown bestätigt den Schmerzpunkt vieler Start-ups: „Die Tankpreise sind hoch, operative Wege kosten Zeit und Geld, und genau dort entsteht oft der nächste Wachstumsschritt.“ Gerade in der frühen Phase zähle jeder Euro.

Der wahre Motor: Dealflow zum Discount-Tarif

Liest man die Ankündigung, wirkt das Projekt sehr wohlwollend. Doch bei genauerer Betrachtung erweist sich der GründerTank als strategisches Meisterstück der Dealflow-Generierung für Obereders Investmentvehikel.

- Geringer Kapitaleinsatz, maximaler Einblick: Die ausgelobten 100.000 Euro sind ein Gesamtbudget. Im Gegenzug für die Chance auf die Übernahme von Zugtickets oder Tankrechnungen reichen unzählige Start-ups ihre Unterlagen und Traktionsdaten ein. Für einen professionellen Investor ist dies ein unschlagbar kostengünstiger Weg, um an hochqualitative, topaktuelle Unternehmensdaten der umtriebigsten Frühphasen-Gründer*innen des Landes zu gelangen. Reguläre Venture-Capital-Fonds geben für das Scouting ein Vielfaches dieses Budgets aus.

- Skalierung durch künstliche Intelligenz: Die Flut an Bewerbungen wird nicht mühsam per Hand sortiert. Die eingereichten Unterlagen werden zunächst KI-gestützt vorbewertet. Die KI dient ausschließlich der Vorbewertung und Priorisierung, bevor am Ende Menschen die finale Auswahl treffen.

- Exzellentes PR-Narrativ: Die Story positioniert Obereder als echten „Hands-on“-Macher und adressiert ein spürbares Problem. Ein Rechtsanspruch auf Teilnahme oder Förderung besteht dabei ausdrücklich nicht, weshalb das finanzielle Risiko für den Initiator absolut gedeckelt ist.

Fazit: Mitfahren, aber smart

Sollten junge Unternehmerinnen und Unternehmer beim GründerTank mitmachen? Die Antwort lautet: Ja, aber mit strategischem Bewusstsein. Für Bootstrapping-Teams bietet das Programm eine unkomplizierte Hilfe. Wer den Zuschlag erhält, gewinnt nicht nur finanzielle Beinfreiheit, sondern landet unweigerlich auf dem Radar eines bestens vernetzten Investors.

Gründer*innen müssen sich jedoch des Tauschgeschäfts bewusst sein: Sie gewähren tiefe Einblicke in ihr Geschäftsmodell, um im Gegenzug potenziell Mobilitätskosten erstattet zu bekommen. Man sollte das Programm daher weniger als reine Spendenaktion betrachten, sondern vielmehr als das, was es im Kern ist: Einer der innovativsten und kosteneffizientesten Start-up-Scouting-Funnel der aktuellen Szene.

BRYCK Startup Alliance: Vom Kohlenpott zum Code-Pott

Das Bundesministerium für Wirtschaft und Energie (BMWE) hat mit den exist Startup Factories ein hochambitioniertes Förderprogramm aufgesetzt. Das Ziel: Wissenschaftliche Erkenntnisse sollen schneller und skalierbarer in die Wirtschaft überführt werden. Eines der Leuchtturmprojekte entsteht derzeit im Ruhrgebiet. Wir werfen einen Blick auf den Status quo der BRYCK Startup Alliance, die Macher*innen im Hintergrund und die Frage, was das Konstrukt Gründenden in der Praxis wirklich bringt.

Deutschland habe ein Transferproblem, so die Analyse der Initiatoren. Während die heimischen Universitäten in der Grundlagenforschung weltweit Spitzengeschwindigkeiten fahren, gerate der Motor ins Stottern, sobald es darum gehe, aus diesen Erkenntnissen marktreife Unternehmen zu formen. Genau hier setzen die geförderten exist Startup Factories an. Sie haben den Auftrag, die Quantität und Qualität wissensbasierter Ausgründungen signifikant zu steigern.

Das Silicon Valley der Schwerindustrie?

Geführt wird die BRYCK Startup Alliance, die 2025 als einer der Sieger des exist-Wettbewerbs gekürt wurde, von einem fünfköpfigen Führungsteam um Geschäftsführer Philipp Herrmann. Herrmann, selbst Seriengründer und Investor, soll die Brücke zwischen akademischer Forschung und traditionellen Corporate-Strukturen schlagen. Das Ziel ist gewaltig: Das Ruhrgebiet soll sich zur führenden Modellregion für industrielle Erneuerung in Europa wandeln.

Warum aber ausgerechnet DeepTech und nicht etwa digitale B2B-Software, wo die Einstiegshürden niedriger wären? Herrmann stellt klar: „Weil wir hier nicht die x-te Region bauen sollten, die versucht, ein kleines Silicon Valley zu spielen.“ Das Ruhrgebiet habe andere Stärken, wie eine enorme Dichte an Hochschulen, Industrie und konkreten Anwendungsfeldern. Für ihn liegt die Zukunft Europas nicht in reinen Softwaremodellen, sondern in Feldern wie Energie, Wasserstoff oder industrieller Effizienz. „DeepTech hat für diese Region einen anderen Hebel“, betont er. Wenn hier etwas funktioniere, habe es echte Wirkung auf industrielle Prozesse und neue Wertschöpfung. Sein Fazit für die Region: „Nicht den schnellsten Hype, sondern den nachhaltigsten Umbau.“

Eine beispiellose Allianz – und potenzielle Corporate-Falle?

Das Fundament der Allianz ist massiv: Die Universitätsallianz Ruhr kooperiert mit der RAG-Stiftung und dem Initiativkreis Ruhr, einem Bündnis aus über 70 Konzernen wie E.ON oder RWE. Für Start-ups klinge das theoretisch nach einem Sechser im Lotto. In der Praxis jedoch drohen agile Gründer*innen oft in den bürokratischen Mühlen der Großkonzerne zu ersticken.

Herrmann räumt unumwunden ein: „Die Gefahr besteht absolut.“ Große Unternehmen seien nicht per se schnell, und Konzernprozesse könnten für junge Teams zermürbend sein. Die Allianz setze daher nicht auf bloßes Networking, sondern auf harte Vorsortierung. „Unser Job ist, viel stärker vorzusortieren: Wo gibt es ein echtes Problem? Wo gibt es auf Unternehmensseite jemanden, der das Thema wirklich treiben will?“ Ein echter „Fast Track“ sei am Ende immer ein gut vorbereiteter Prozess. Zwar werde dadurch nicht jede Reibung verschwinden, aber man könne die Wahrscheinlichkeit für erfolgreiche Pilotprojekte massiv erhöhen.

Status quo: Die Realitätsprüfung

Seit dem Start ist viel passiert: Weit über 130 Start-ups haben die Programme bereits durchlaufen. Zudem wurde mit „GF BRYCK Ventures“ ein 10-Millionen-Euro-Fonds für Frühphasen-Investments etabliert. Doch Herrmann gibt zu, dass zwischen Masterplan und Realität oft Welten liegen.

Besonders die Kluft zwischen Universität, Start-up und Konzern habe ihn in der täglichen Arbeit gefordert. Man habe gelernt, dass ein gutes Ökosystem neben einem „Nordstern“ vor allem „sehr viel operative Kleinarbeit an all den zu verändernden Schnittstellen“ benötige. DeepTech sei eben kein Sprint. „Das Ruhrgebiet verändert man auch nicht mit einer großen Überschrift“, so Herrmann. Vielmehr verändere man es Schritt für Schritt durch funktionierende Beispiele.

Der harte Weg aus dem Labor

Zwei der größten „Start-up-Killer“ bei Uni-Ausgründungen sind ungeklärte Patentrechte (IP) und einseitige Teams aus Forschenden ohne Vertriebserfahrung. Herrmann fordert hier bei den IP-Prozessen vor allem Geschwindigkeit und Verlässlichkeit. „Nichts ist schädlicher als Monate der Unklarheit.“

Gleichzeitig legt er den Fokus auf das Matching der Teams. Während die „Nerds“ aus dem Labor für die Technologie unverzichtbar seien, entstehe ein Unternehmen erst, wenn technologische Exzellenz und unternehmerische Kompetenz zusammenkommen. Er plädiert für ein neues Selbstverständnis: „Ich finde auch, wir müssen weg von diesem alten Denken, dass Forschung und Unternehmertum zwei getrennte Welten seien. Im Idealfall ist Unternehmertum der Weg, wie aus guter Forschung Wirkung wird.“

Was kostet die Förderung?

Mit dem neuen Fonds investiert die Allianz bis zu 300.000 Euro in der ganz frühen Phase. Pauschale Deal-Terms gebe es dabei bewusst nicht, da die Situationen der Teams zu unterschiedlich seien. Herrmann betont jedoch ein wichtiges Prinzip: „Frühphasenfinanzierung darf Gründer nicht klein, sondern muss sie handlungsfähig machen.“

Da 300.000 Euro bei DeepTech-Hardware oft nur ein Anfang sind, müsse man das „Valley of Death“ durch breitere Kapitalzugänge schließen. Er sieht hier eine große Aufgabe für ganz Europa: „Wir brauchen mehr geduldiges Kapital und bessere Anschlussfinanzierung für wissenschaftsbasierte Unternehmen.“ Ziel sei es, die Teams so aufzustellen, dass sie auch die nächste und übernächste Runde erreichen können.

Ausblick: Eine Milliarde fürs Ruhrgebiet

Bis 2030 sind die Ziele messbar: 1.000 wissenschaftsbasierte Ausgründungen und eine Milliarde Euro mobilisiertes Risikokapital. Ob das Projekt ein Erfolg wird, mache Herrmann an substanziellen Ergebnissen fest.

„Im Kern werden wir nur dann wirklich Strahl- und Magnetkraft auf europäischer Ebene entwickeln, wenn aus unseren Startups groß skalierte Unternehmen entstehen – wirkliche Unicorns, die Industrien verändern“, kontert er. Man müsse beweisen, dass hier Firmen entstehen, die industrielle Probleme auf Weltklasseniveau lösen. Sein Wunsch für die nächsten vier Jahre: „Dass das kein spannendes Einzelprojekt mehr ist, sondern ein funktionierendes System mit echter Zugkraft.“ Wenn die ersten Teams aus diesem System zu echten Erfolgsgeschichten werden, sei das der stärkste Beleg für den Erfolg.

Factsheet: BRYCK Startup Alliance auf einen Blick

- Offizieller Name: BRYCK Startup Alliance

- Fokus: DeepTech, B2B, industrielle Transformation

- Status: Prämierte exist Startup Factory des BMWE (Entscheidung am 10. Juli 2025)

- Geschäftsführung: Philipp Herrmann, Dr. Christian Lüdtke, Philippa Köhnk, Ersin Üstün, Maximilian Weil-Schimanski

- Wissenschaftliches Rückgrat: Universitätsallianz Ruhr (Bochum, Dortmund, Duisburg-Essen)

- Wirtschaftliches Netzwerk: Initiativkreis Ruhr (über 70 Top-Unternehmen) & RAG-Stiftung

- Finanzierung: GF BRYCK Ventures (10 Mio. Euro Fonds, Tickets bis zu 300.000 Euro)

- Ziele bis 2030: 1.000 Ausgründungen, 200 skalierende DeepTech-Start-ups, 1 Mrd. Euro mobilisiertes Kapital

- Website: bryckstartupalliance.com/de

Brainjo: 2-Mio-EUR-Spritze für die Therapie-Brille

Lange Wartelisten und ein überlastetes Gesundheitssystem: Das Regensburger Start-up brainjo will die Lücken in der klassischen Psychotherapie mit Virtual Reality (VR) schließen.

Das Digital-Health-Start-up brainjo hat erfolgreich eine Seed-Finanzierung in Höhe von zwei Millionen Euro abgeschlossen. Angeführt wird die Finanzierungsrunde vom High-Tech Gründerfonds (HTGF). Zu den weiteren Geldgebern gehören die MEDICE Health Family als strategischer Partner sowie Business Angels, darunter der Regensburger Investor Andreas Weinhut und der Münchner VC better ventures. Mit dem frischen Kapital finanziert das Unternehmen den Start einer klinischen Studie und treibt die Zulassung seiner ersten digitalen Gesundheitsanwendung (DiGA) voran.

Von der Studenten-Idee zum Digital-Health-Start-up

Hinter brainjo steht ein zehnköpfiges, interdisziplinäres Team, das Expertise aus den Bereichen Technologie, Psychologie und Gesundheit vereint. Gegründet wurde die brainjo GmbH im Jahr 2022 mit Sitz in Regensburg. Die Wurzeln des Unternehmens liegen in einem Ausgründungsprojekt der Ostbayerischen Technischen Hochschule (OTH) Regensburg. Die Gründer – allen voran Christian Gnerlich, Alexander Pilling und Constantin Demigha – begannen bereits 2021 in der lokalen TechBase mit der Vision, Gehirntraining durch Virtual Reality greifbar zu machen.

Was als Projekt für generelle "Mental Fitness" startete, hat sich mittlerweile zu einem klinisch fundierten Ansatz im Bereich Digital Health weiterentwickelt. Heute lenken Markus Wensauer (Co-Founder und CEO) und Christian Gnerlich das operative Geschäft, während Alexander Pilling die VR-Entwicklung verantwortet.

Das Produkt: Psychotherapie im Gaming-Gewand

Brainjo entwickelt VR-basierte DiGAs für die Psychotherapie. Diese sollen künftig von Therapeut*innen oder Ärzt*innen verordnet und von den Krankenkassen erstattet werden. Der Ansatz des Start-ups ist es nicht, die klassische Psychotherapie zu ersetzen, sondern die teils gravierenden Versorgungslücken des Systems zu schließen. Patient*innen sollen so von zuhause aus Zugang zu einer immersiven und individualisierten Behandlungsform erhalten.

Die erste Anwendung richtet sich an Kinder mit ADHS und entsteht in direkter Kooperation mit der MEDICE Health Family. Um die oft geringe Therapiemotivation der jungen Zielgruppe zu knacken, setzt brainjo stark auf Gamification. Die Kinder tauchen per VR in virtuelle Welten ein und trainieren dort durch spielerische Elemente Alltagssituationen und kognitive Fähigkeiten. Laut HTGF-Principal Dr. Jörg Traub unterscheidet sich das Start-up genau durch diese Tiefe der Immersion von reinen Software-Lösungen, was einen klinisch relevanten Ansatz darstelle, um die Therapietreue (Adhärenz) signifikant zu steigern.

Der strategische Schachzug von MEDICE

Der Markt für Therapie auf Rezept (DiGA) ist in Deutschland stark umkämpft. Im Segment ADHS formiert sich bereits handfeste Konkurrenz:

- Bei Erwachsenen: Im Sommer 2025 wurde mit der App ORIKO (entwickelt von Takeda und MiNDNET) die erste DiGA für erwachsene ADHS-Patient*innen in das offizielle Verzeichnis des Bundesinstituts für Arzneimittel und Medizinprodukte (BfArM) aufgenommen.

- Im Kinder- und Jugendbereich: Mit hiToco existiert bereits ein etabliertes, Smartphone-basiertes Elterntraining für Kinder zwischen 4 und 11 Jahren (Zulassung ebenfalls Mitte 2025).

Besonders interessant: Hinter hiToco steht die medigital GmbH – eine Tochter der MEDICE Health Family. Der Einstieg von MEDICE bei brainjo ist daher mehr als nur ein finanzielles Investment. Der Pharmakonzern baut sich hier offensichtlich ein lückenloses, digitales ADHS-Ökosystem auf: hiToco für die Schulung der Eltern, brainjo für die direkte VR-Therapie der Kinder.

Unsere Einordnung

Der technologische Ansatz von brainjo ist vielversprechend und adressiert mit langen Wartelisten in der Psychotherapie ein massives gesellschaftliches Problem. Die strategische Einbettung in das MEDICE-Portfolio ist ein cleverer Hebel. Dennoch muss sich das Modell in den kommenden Jahren harten Herausforderungen stellen:

- Die Hardware-Hürde: Anders als eine einfache Smartphone-App erfordert die Lösung von brainjo teure VR-Brillen. Wer bezahlt die Hardware? Krankenkassen übernehmen in der Regel nur die Kosten für die reine DiGA-Nutzungslizenz. Wenn Eltern in Vorleistung gehen müssen oder ein aufwendiges Leih-System etabliert werden muss, verliert die Therapie ihren propagierten skalierbaren und einfachen Zugang.

- Zulassung und Zeitplan: Die Marktzulassung ist erst für 2028 geplant. Im schnelllebigen Start-up-Sektor ist das eine halbe Ewigkeit. Bis dahin muss brainjo mit den frischen zwei Millionen Euro den Betrieb sichern und vor allem die anstehende klinische Studie erfolgreich durchführen. Ohne wasserdichte Evidenzdaten platzt der Traum der BfArM-Zulassung.

- Akzeptanz bei Eltern und Behandler*innen: Eine immersive VR-Welt löst bei Kindern Begeisterung aus – bei Eltern potenziell Skepsis. Das Team muss pädagogisch überzeugend belegen, dass die zusätzliche „Bildschirmzeit“ unter der Brille einen rein therapeutischen Zweck erfüllt und eine ohnehin bestehende Reizüberflutung bei ADHS-Patient*innen nicht noch verstärkt.

Fazit

Brainjo verlässt die ausgetretenen Pfade der 2D-Apps und wagt sich an die hochkomplexe Schnittstelle zwischen VR-Hardware, Gaming und klinischer Therapie. Gelingt der klinische Wirksamkeitsnachweis und lässt sich die Verteilung der Hardware logistisch reibungslos organisieren, könnte das Start-up die Psychotherapie nachhaltig verändern. Bis 2028 bleibt dieses Vorhaben jedoch ein kapitalintensiver Ausdauerlauf.

Synera sichert sich 35 Mio. Euro für die Revolution des Engineerings

Was einst als bionisches Forschungsprojekt begann, ist heute eine der vielversprechendsten europäischen DeepTech-Hoffnungen. Doch wie tragfähig ist die Vision vom „autonomen digitalen Ingenieur“ im stark regulierten Maschinenbau? Ein tieferer Blick auf Gründer, Markt und das Geschäftsmodell.

Die deutsche Industrie steht unter massivem Druck: Internationale Konkurrenz – insbesondere aus Asien –, chronischer Fachkräftemangel und die Notwendigkeit, Entwicklungszyklen drastisch zu verkürzen, zwingen zum Handeln. Generative künstliche Intelligenz (GenAI) gilt als Heilsbringer, doch in der Praxis verpuffen viele Initiativen. Nur etwa 41 Prozent der KI-Prototypen in der Fertigungsindustrie erreichen laut Branchenstudien den produktiven Einsatz. Die Konstruktions- und Entwicklungsabteilungen gelten als stark in Silos organisiert und bis heute schwer automatisierbar.

„Engineering ist das Rückgrat jedes Industrieunternehmens, gehört jedoch nach wie vor zu den am wenigsten digitalisierten und automatisierten Funktionen und war bis vor Kurzem für KI weitgehend unzugänglich“, bringt es Dr. Moritz Maier, Co-CEO von Synera, auf den Punkt.

Genau in diese Lücke stößt sein Unternehmen. Mit einer Series-B-Finanzierungsrunde über 35 Millionen Euro will das Bremer Startup nun international skalieren. Angeführt wird die Runde vom europäischen Wachstumsfonds Revaia, mit starker Beteiligung des UVC Partners Wachstumsfonds sowie Capgemini (über ISAI Cap Ventures). Auch die Bestandsinvestoren Spark Capital, BMW iVentures und Cherry Ventures ziehen wieder mit. Das Signal an den Markt ist deutlich: Engineering Automation wird zum nächsten großen Software-Schlachtfeld.

Von Kieselalgen zur KI-Plattform

Hinter Synera stehen die Gründer Moritz Maier, Daniel Siegel (beide Co-CEO) und Sebastian Möller (Managing Director). Die Ursprungsidee entstand am renommierten Alfred-Wegener-Institut (AWI) in Bremerhaven. Die Gründer forschten dort im Bereich der Bionik und untersuchten die Leichtbaustrukturen von Kieselalgen, um deren evolutionäre Prinzipien auf technische Bauteile zu übertragen.

Aus „Evolutionary Light Structure Engineering“ wurde 2018 die Ausgründung ELISE. Zunächst lag der Fokus auf algorithmusbasiertem Design. Mit der Zeit erkannten die Gründer jedoch ein viel grundlegenderes Problem: Es fehlte nicht an Software für das eigentliche Design, sondern an einer Brücke, die die unzähligen Insellösungen (CAD, Simulation, Materialprüfung) im Engineering-Alltag verbindet. Dies führte zur Neuausrichtung und schließlich zur Umbenennung in Synera – einer Low-Code- und KI-Plattform für Connected Engineering.

Das Geschäftsmodell im Check

Synera betreibt ein klassisches B2B-Plattform-Modell. Anstatt etablierte Platzhirsche im Computer-Aided Design (CAD) zu verdrängen, positioniert sich Synera als übergeordnete Orchestrierungsschicht. Die Software klinkt sich in über 80 bestehende Tools ein.

- Der Werttreiber: Nutzer*innen können komplexe Workflows (z. B. CAD-Modellierung → Simulation → Kostenkalkulation → Designanpassung) als Templates speichern. Das frische Kapital soll laut Moritz Maier nun eine Entwicklung beschleunigen, „bei der KI-Agenten als echte digitale Engineers agieren und komplexe Workflows entlang der gesamten Wertschöpfungskette autonom ausführen.“

- Der Lock-in-Effekt: Wenn ein Industriekonzern seine Kernprozesse auf Synera automatisiert hat, ist die Plattform kaum noch auszutauschen. Die Wechselkosten für den Kunden sind enorm.

- Die Herausforderungen: Das Modell ist technisch hochkomplex. Die ständige Pflege von über 80 API-Schnittstellen zu Drittanbietern bindet gewaltige Entwickler*innen-Ressourcen. Zudem erfordert der Vertrieb in klassische Hardware-Unternehmen lange Sales-Zyklen.

Zwischen RPA und Spezial-CAD

Wettbewerbsumfeld | Marktansatz | Syneras Differenzierung |

Generatives Design (z. B. nTop, Altair) | Fokus auf die Erstellung hochkomplexer, gewichtsoptimierter Bauteile. | Synera generiert nicht nur das Design, sondern automatisiert den Prozess quer durch verschiedene externe Tools. |

Klassische RPA (z. B. UiPath, Zapier) | Hervorragend für kaufmännische Prozesse (HR, CRM, Rechnungen). | Standard-RPA scheitert an den komplexen 3D-Geometrie- und Physikdaten des Engineerings. |

PLM-Systeme (z. B. Siemens, Dassault) | Verwalten den gesamten Produktlebenszyklus und die Daten. | Synera setzt sich auf diese oft schwerfälligen Systeme, um die agilen Arbeitsschritte flexibler zu machen. |

Kritische Einordnung: Vertraut der/die Ingenieur*in der KI?

Synera verweist auf eine Umsatzverdopplung im vergangenen Jahr und über 60 namhafte Kunden, darunter BMW, Airbus, NASA und Miele. Mit dem frischen Kapital steht die Expansion nach Asien, Europa und in die USA an. Dass dieser Wachstumskurs von den Investoren aktiv gestützt wird, betont Benjamin Erhart, General Partner bei UVC Partners: „Wir konnten erleben, wie Synera als zuverlässiger Partner die Transformation des Engineerings gestaltet.“

Doch der Weg zur breiten Durchdringung birgt auch Stolpersteine:

- Das Vertrauensproblem: „Agentic AI“ bedeutet, dass die Software eigenständig Entscheidungen trifft. In sicherheitskritischen Branchen (Luftfahrt, Automotive) herrschen jedoch strikte Compliance-Regeln. Bevor ein KI-Agent autonome Designänderungen an tragenden Bauteilen vornimmt, müssen massive Haftungsfragen geklärt sein.

- Die Pilot-Falle: Viele GenAI-Projekte scheitern auf dem Weg in die Produktion. Die Gefahr für Synera besteht darin, in Innovationsabteilungen stecken zu bleiben, während das operative Kerngeschäft aus Kostengründen an bewährten Methoden festhält.

- Die API-Abhängigkeit: Wer als Brückenbauer*in zwischen Dutzenden Software-Silos agiert, macht sich von den Anbietern abhängig. Sperrt ein großer CAD-Anbieter seine API, trifft dies Syneras Modell im Kern.

Fazit

Synera ist ein exzellentes Beispiel dafür, wie aus akademischer Grundlagenforschung ein hoch skalierbares DeepTech-Produkt werden kann. Der strategische Pivot vom reinen Design-Tool zur prozessübergreifenden Plattform zahlt sich durch die starke Series B nun aus. Gelingt es den Bremern, den eher konservativen globalen Maschinenbau davon zu überzeugen, dass KI-Agenten die menschlichen Ingenieur*innen nicht ersetzen, sondern befähigen, könnte Synera der entscheidende globale Standard im Connected Engineering werden.

Peak Quantum sichert sich 2,2 Mio. Euro für fehlerresistente Qubits

Peak Quantum holt 2,2 Mio. Euro für fehlerresistente Qubits. Wie das Münchner Spin-off mit EU-Förderung gegen die hochgerüstete Konkurrenz antritt.

München wächst weiter als Europas Quanten-Hauptstadt. Das Start-up Peak Quantum schließt seine Pre-Seed-Runde mit 2,2 Millionen Euro ab und positioniert sich im hart umkämpften Deep-Tech-Markt. Der Pitch der Gründer: Fehlerkorrektur direkt in der Hardware. Doch in einem extrem kapitalintensiven Umfeld reicht Geld allein nicht. Wie das Spin-off mit einem cleveren Infrastruktur-Schachzug gegen die hochgerüstete europäische Konkurrenz bestehen will.

Aus der Forschung in die Praxis

Im Jahr 2024 entstand Peak Quantum als Spin-off aus der Forschungsgruppe von Prof. Stefan Filipp am Walther-Meißner-Institut (WMI), das zur Bayerischen Akademie der Wissenschaften gehört. Das Gründungsteam deckt interdisziplinär die gesamte Wertschöpfungskette vom Chipdesign bis zur Systemintegration ab. Zu den Köpfen hinter der Unternehmung gehören Leon Koch (CEO), Alexander Schult (CFO), Dr. Thomas Luschmann (COO), Dr. Max Werninghaus (CSO), Ivan Tsitsilin (Head of Design), Kedar Honasoge (Head of Production) und Daniil Bazulin (Quantum Engineer). Unterstützt wird das junge Unternehmen durch wichtige Säulen des lokalen Ökosystems wie dem Munich Quantum Valley und der UnternehmerTUM.

„Hardware-First“ statt Software-Pflaster

Das aktuell größte Hindernis im Quantencomputing ist das sogenannte Rauschen – die enorme Fehleranfälligkeit der Recheneinheiten (Qubits). Während die Industrie bisher stark darauf setzte, schlicht die Anzahl physikalischer Qubits hochzuskalieren und Fehler nachträglich per Software zu korrigieren, wählt Peak Quantum einen grundlegend anderen Weg. Das Start-up entwickelt supraleitende Prozessoren, deren physikalische Architektur Fehler bereits auf der reinen Hardware-Ebene unterdrückt. Dieser integrierte Fehlerschutz soll die Komplexität des Gesamtsystems drastisch senken und die Entwicklung kommerziell nutzbarer Rechner massiv beschleunigen.

Das Geschäftsmodell & der EU-Infrastruktur-Hebel

Quanten-Hardware ist ein unfassbar teures Pflaster. Mit dem frischen Kapital von Investor*innen wie dem britischen Lead-Investor Cloudberry Ventures, United Founders oder QAI Ventures steigt die Gesamtfinanzierung von Peak Quantum auf gut fünf Millionen Euro. Für den Aufbau eigener Reinräume (CapEx) reicht das kaum. Der strategische Clou des Geschäftsmodells liegt daher in der europäischen Vernetzung: Peak Quantum bezieht öffentliche Fördermittel aus dem EU Chips Act und wurde ausgewählt, die im April 2026 startende Quantenchip-Pilotlinie SUPREME zu betreiben.

Ziel ist es, in Europa eine skalierbare Produktionsumgebung zu etablieren, die langfristig auch für externe Partner geöffnet werden soll. Ein Modell, das es Peak Quantum erlaubt, trotz einer frühen Finanzierungsphase hocheffizient an industrietauglichen Chips zu feilen.

Der Markt & die Konkurrenz

Doch der Markt verzeiht keine Verzögerungen, und München ist längst ein Haifischbecken der Quantentechnologie. Direkt vor der Haustür sitzen Schwergewichte:

- IQM Quantum Computers: Der europäische Platzhirsch für supraleitende Quantencomputer (mit Hauptsitz in Finnland, aber großem Zentrum in München), der kürzlich eine SPAC-Fusion für einen geplanten Milliarden-Börsengang ankündigte.

- planqc: Ein weiteres Münchner Spin-off, das auf neutrale Atome setzt und bereits 2024 eine Series A in Höhe von satten 50 Millionen Euro abschloss.

- Alice & Bob: Auf internationaler Ebene steht besonders das französische Start-up Alice & Bob in direkter technischer Konkurrenz. Die Pariser entwickeln sogenannte Cat Qubits, die ebenfalls hardwareseitig fehlerresistent sind, und kooperieren dabei bereits eng mit Microsofts Quanten-Sparte.

Fazit: Risiko und enorme Chance

Das Board rund um einen ehemaligen Alphabet-X-Advisor sieht in Peak Quantum ein elementares Puzzleteil für ein eigenständiges europäisches Quanten-Ökosystem. Die Investition ist ein klassisches „Deep-Tech-Infrastruktur-Play“.

Dennoch ist eine Pre-Seed-Runde von 2,2 Millionen Euro im Jahr 2026 angesichts der Kapitalausstattung der Konkurrenz eine riskante Wette. Peak Quantum muss durch den Zugang zur SUPREME-Pilotlinie extrem schnell beweisen, dass die fehlerresistente Architektur industriell skaliert und nicht nur im Labor des WMI funktioniert.

Bringt das Team um Leon Koch erste greifbare Pilotprojekte mit Forschungs- und Industriepartnern in den Bereichen Materialforschung, Logistik oder industrieller Optimierung zum Laufen, könnte Peak Quantum zu einem technologischen Flaschenhals werden, an dem in Europa niemand mehr vorbeikommt. Es ist das Paradebeispiel dafür, wie smarte Gründer*innen nicht nur Code oder Hardware schreiben, sondern das System aus Fördergeldern, Pilotlinien und lokaler Forschungsexzellenz maximal zu ihrem Vorteil hebeln.

50 Mio. US-Dollar-Series A-Runde für Berliner FinTech Midas

Das 2024 von Dennis Dinkelmeyer, Fabrice Grinda und Romain Bourgois gegründete Web3-Start-up Midas sammelt 50 Mio. $ ein, um tokenisierte Vermögenswerte sofort liquide zu machen. Das frische Kapital soll primär in die Entwicklung und Skalierung der sogenannten Midas Staked Liquidity (MSL) fließen.

Der Markt für tokenisierte Vermögenswerte (Real World Assets, kurz RWA) wächst rasant, leidet jedoch noch immer an einer strukturellen Hürde: Während Kryptomärkte rund um die Uhr in Echtzeit handeln, sind traditionelle Finanzprodukte im Hintergrund oft an klassische, mehrtägige Abwicklungszyklen gebunden. Wenn Investor*innen ihre Token in liquide Mittel zurücktauschen wollen, kommt es unweigerlich zu Verzögerungen. Genau diese Lücke will das Berliner FinTech Midas nun schließen und hat dafür massiv Kapital aufgenommen.

Wie das Unternehmen heute mitteilte, flossen in einer Series-A-Finanzierungsrunde 50 Millionen US-Dollar (rund 46 Millionen Euro). Angeführt wird die Runde von den Venture-Capital-Firmen RRE Ventures und Creandum. Zu den weiteren Geldgebern zählen namhafte Branchengrößen wie Framework Ventures, Coinbase Ventures sowie der traditionelle Vermögensverwalter Franklin Templeton, der selbst bereits stark im Bereich tokenisierter Anlageprodukte aktiv ist. Mit der aktuellen Runde steigt das Gesamtfinanzierungsvolumen des Start-ups auf knapp 59 Millionen US-Dollar.

Das Gründerteam aus TradFi und Web3

Hinter Midas, das 2024 gegründet wurde, steht ein Team, das tiefes Wissen aus der traditionellen Finanzwelt (TradFi), dem Venture Capital und dem dezentralen Finanzsektor (DeFi) vereint. An der Spitze steht CEO und Mitgründer Dennis Dinkelmeyer, der vor der Gründung im Investment Research bei Branchengrößen wie Goldman Sachs und der Capital Group tätig war. Er bringt das essenzielle Verständnis für die Strukturierung institutioneller Anlageprodukte in die Blockchain-Welt ein.

Ergänzt wird die Führungsriege durch Executive Chairman und Mitgründer Fabrice Grinda. Als Gründungspartner des Investmentfonds FJ Labs gehört Grinda zu den weltweit aktivsten Angel-Investoren. Er steuert neben Kapital und einem enormen Netzwerk auch operative Erfahrung bei, die er unter anderem als Co-Gründer der für über eine Milliarde US-Dollar übernommenen Plattform OLX sammelte. Komplettiert wird das Führungstrio von Mitgründer Romain Bourgois. Der Tech-Experte war fast ein Jahrzehnt in leitenden Produktrollen beim AdTech-Giganten Criteo tätig, bevor er als Head of Product zum US-Konkurrenten Ondo Finance wechselte. Dort leistete er maßgebliche Pionierarbeit bei der Entwicklung und Skalierung der ersten großen tokenisierten US-Staatsanleihen, wie etwa OUSG und USDY.

Fokus auf „Midas Staked Liquidity“ (MSL)

Das frische Kapital soll primär in die Entwicklung und Skalierung der sogenannten Midas Staked Liquidity (MSL) fließen. Dabei handelt es sich um einen dedizierten Liquiditätspuffer, gegen den die firmeneigenen Token (mToken) jederzeit und ohne Wartezeit eingelöst werden können. Für institutionelle Investoren, die Treasury- und Portfolio-Management auf der Blockchain betreiben, ist diese sofortige Liquidität ein entscheidendes Kriterium.

Bisher mussten Rendite-Investoren oft zwischen der sofortigen Handelbarkeit und den Erträgen von DeFi-Protokollen abwägen – MSL soll diesen Kompromiss überflüssig machen. Die Midas-Plattform überführt dafür institutionelle Anlagestrategien, wie etwa Staatsanleihen (mTBILL) oder Basis-Handelsstrategien (mBASIS), in regulierungskonforme Token, die nahtlos in DeFi-Netzwerke wie Morpho oder Pendle integriert werden können. Nach eigenen Angaben hat Midas seit dem Start Token im Gesamtwert von über 1,7 Milliarden US-Dollar emittiert und dabei Erträge in Höhe von 37 Millionen US-Dollar an seine mehr als 20.000 Nutzer ausgeschüttet. Das Fintech finanziert sich dabei über Gebühren, die auf diese erwirtschafteten Renditen erhoben werden.

Die Brücke zwischen Wall Street und Blockchain

„Wir arbeiten auf eine Zukunft hin, in der Investitionen wie das Internet funktionieren: offen, transparent, kombinierbar und standardmäßig zugänglich“, formuliert CEO Dennis Dinkelmeyer den Anspruch des Unternehmens. Vic Singh, General Partner bei RRE Ventures, teilt diese Vision: Die Tokenisierung werde die globalen Kapitalmärkte fundamental verändern, sobald die traditionelle Finanzwelt ihre Infrastruktur vollständig auf die Blockchain verlagere.

Neben der Etablierung von MSL plant Midas, das frische Kapital für die Erschließung weiterer Anlageklassen und den Ausbau von Partnerschaften zu nutzen. Mit dem Einstieg von Schwergewichten wie Franklin Templeton und Coinbase Ventures positioniert sich das 2024 gegründete Unternehmen damit als einer der zentralen Infrastrukturanbieter an der lukrativen Schnittstelle zwischen klassischem Finanzwesen und der Krypto-Ökonomie.

Gründer*in der Woche: SpeakerMatching.com – Disruption auf der Bühne

Die Eventbranche wächst, doch die Suche nach den passenden Köpfen für die Bühne gleicht oft noch einem analogen Kraftakt. Mit der Plattform SpeakerMatching.com will eine erfahrene Seriengründerin den Spieß nun umdrehen. Es ist ein klassisches Plattform-Play ohne die üblichen Vermittlungsprovisionen – doch kann sich das Modell gegen etablierte Branchengrößen durchsetzen? Wir haben die Gründerin Henriette Hochstein-Frädrich befragt.

Hinter SpeakerMatching.com, im November 2025 als B2B-Marktplatz gelauncht, steht Henriette Hochstein-Frädrich. Sie kennt den Schmerz der Branche nicht nur vom Hörensagen. „Ich kenne den Markt nicht nur als Plattformunternehmerin, sondern auch aus zwei weiteren sehr praktischen Perspektiven: Seit vielen Jahren stehe ich selbst als Speakerin und Moderatorin auf Bühnen, und zugleich habe ich eigene Eventformate und Veranstaltungsreihen im Bereich modernes Female Empowerment konzipiert und umgesetzt“, erinnert sich die Gründerin.

„Gerade als Veranstalterin wurde mir immer wieder bewusst, wie zeitaufwendig, intransparent und teilweise zufallsgetrieben die Suche nach passenden Rednerinnen sein kann“, bringt sie das Kernproblem auf den Punkt. Gleichzeitig habe sie beobachtet, wie sich der Markt zunehmend professionalisiere: „Es gibt mehr Expertinnen, mehr Themen, mehr Formate, aber bislang keine wirklich zeitgemäße digitale Infrastruktur, die Angebot und Nachfrage effizient zusammenführt.“

Dass sie diese Infrastruktur bauen kann, hat sie in der Vergangenheit bewiesen: 2009 gründete sie Pharmatching.com, baute es zur Branchengröße auf und verkaufte es 2017. „Aus meinen früheren Plattformgründungen habe ich vor allem drei zentrale Lektionen mitgenommen: Erfolgreiche Marktplätze lösen ein echtes, konkretes Problem. Vertrauen und Qualität sind im B2B-Umfeld entscheidend. Und nicht zuletzt spielt Timing eine größere Rolle, als viele denken“, betont Hochstein-Frädrich.

Rollentausch statt Kaltakquise

Das Timing sei deshalb ideal, weil Veranstaltende heute Plattformlogiken und Self-Service-Modelle erwarten, wie sie sie aus anderen B2B-Märkten längst kennen. Der Kern von SpeakerMatching.com liegt in der Umkehrung des klassischen Buchungsprozesses. Veranstaltende formulieren ihr Gesuch kostenfrei auf der Plattform, woraufhin sich Speaker*innen direkt bewerben können. Das Start-up finanziert sich stattdessen über Abonnements für die Rednerinnen.

„Uns war von Anfang an wichtig, ein sehr niedrigschwelliges und zugleich faires Preismodell für Speaker*innen zu schaffen“, rechnet die Geschäftsführerin vor. Die monatlichen Mitgliedschaften liegen zwischen rund 59 und 89 Euro. „Wenn über die Plattform ein einzelner Auftrag im mittleren vierstelligen Bereich zustande kommt, hat sich die Investition für viele Redner*innen bereits mehrfach amortisiert.“ Sie stellt aber auch klar: „SpeakerMatching.com ist ein Marktplatz, kein Management- oder Vermittlungsvertrag.“

Doch wie verhindert man eine Flut an unpassenden Bewerbungen? „Die Sorge vor einer unüberschaubaren Bewerbungsflut ist absolut nachvollziehbar, gerade bei offenen Plattformmodellen“, räumt die Gründerin ein. Da Veranstaltende jedoch Parameter wie Budget, Zielgruppe oder Sprache sehr konkret vorgeben, entstehe eine starke Vorfilterung. „Unsere bisherigen Erfahrungen aus den ersten Monaten zeigen sehr deutlich: Unpassende ‚Blindbewerbungen‘ sind die absolute Ausnahme“, versichert Hochstein-Frädrich. Zwar sollen perspektivisch KI-basierte Funktionen eine stärkere Rolle spielen, doch die Vision bleibt menschlich: „Unser Ziel ist daher kein vollständig automatisiertes ‚Black-Box-Matching‘, sondern eine intelligente Plattform, die Entscheidungsprozesse vereinfacht und die Qualität der Interaktionen erhöht.“

Um das Problem des Bypassings – also den Abschluss an der Plattform vorbei – zu umgehen, werden Event-Gesuche zunächst anonymisiert veröffentlicht. „Erst wenn sie passende Bewerbungen erhalten und aktiv in den Austausch gehen möchten, geben sie ihre Identität preis“, erklärt die Gründerin den Prozess. „Wenn Speaker*innen über SpeakerMatching.com kontinuierlich relevante Anfragen erhalten und Veranstaltende effizient passende Expertinnen finden, entsteht eine stabile Win-Win-Dynamik. Genau darauf ist das Modell ausgelegt.“

Markt, Wettbewerb und organisches Wachstum

Der Markt wächst kontinuierlich, wird aber von großen Redneragenturen wie Speakers Excellence oder Premium Speakers dominiert. Diese arbeiten stark kuratiert und rufen oft hohe Vermittlungsprovisionen auf. Um in diesem zweiseitigen Markt das klassische Henne-Ei-Problem zu überwinden, verzichtet die Plattform auf der Veranstaltendenseite auf Gebühren.

Finanziert ist das Vorhaben bisher weitgehend aus eigener Kraft. „Aus meinen früheren Gründungen weiß ich, wie wichtig es gerade in der frühen Phase eines zweiseitigen Marktplatzes ist, Produkt, Zielgruppe und Marktmechanik zunächst sehr präzise zu verstehen und organisch zu entwickeln“, lautet ihr Credo. „Plattformmodelle brauchen Zeit, Vertrauen und kritische Masse, das lässt sich nicht ausschließlich mit Kapital ‚beschleunigen‘, sondern vor allem durch konsequenten Nutzen für beide Marktseiten“.

Dabei grenzt sie sich bewusst von stark kuratierten Agenturen ab. Der Mix aus etablierten Persönlichkeiten und neuen Stimmen sei genau das, was der Markt heute suche. Viele Unternehmen wünschen sich heute bewusst mehr Vielfalt auf ihren Bühnen. „Dabei verstehen wir Diversität nicht nur im klassischen demografischen Sinn, sondern auch als Vielfalt an Perspektiven, Erfahrungen und Denkweisen“, so Hochstein-Frädrich.

Den Vorstoß in Richtung Full-Service-Agenturen samt Ausfallversicherungen bremst sie indes ab. „Im Moment konzentrieren wir uns bewusst darauf, das Matching selbst so gut wie möglich zu machen. Alles Weitere kann – zumindest vorerst – auch von anderen Playern im Ökosystem übernommen werden.“

Fazit

Das Speaker-Business ist traditionell ein echtes People Business. Bei Keynotes für teils fünfstellige Honorare verlassen sich viele Großkund*innen gern auf die persönliche Beratung einer Agentur, die im Krankheitsfall sofort für Ersatz sorgt. Diesen Full-Service kann ein Self-Service-Marktplatz aktuell nur schwer vollumfänglich abbilden.

Dennoch ist SpeakerMatching.com ein mutiger und zeitgemäßer Angriff auf die verkrusteten und provisionsgetriebenen Strukturen der Eventbranche. Gelingt es, rasch eine kritische Masse an hochwertigen Event-Gesuchen zu generieren, hat die Plattform das Potenzial, Angebot und Nachfrage künftig deutlich schneller zusammenzubringen.

Mediennutzung 2026: Zwischen KI-Frust, Abo-Müdigkeit und neuen Chancen für Start-ups

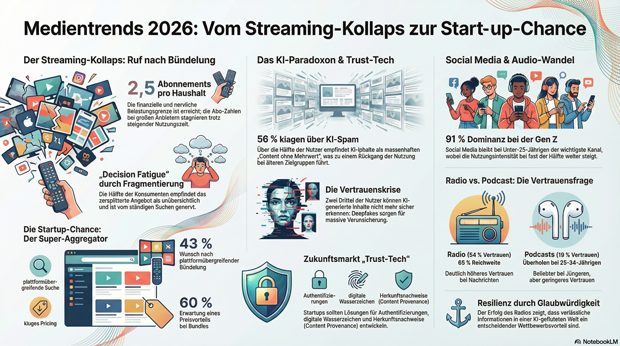

Die Deutschen experimentieren so intensiv wie nie mit künstlicher Intelligenz (KI), sind aber zunehmend genervt von Deepfakes und „Content ohne Mehrwert“. Gleichzeitig sehnt sich der überhitzte Streaming-Markt nach einer drastischen Konsolidierung. Die aktuelle Deloitte-Studie „Media Consumer Trends 2026“ liefert nicht nur Bestandsaufnahmen, sondern zeigt deutlich, wo für Gründer*innen und Tech-Unternehmen jetzt die wahren Opportunitäten liegen.

Social Media bleibt der unangefochtene Platzhirsch der Medienlandschaft: 78 Prozent der Konsument*innen in Deutschland sind auf den Plattformen aktiv, bei der Gen Z (unter 25 Jahre) sind es sogar satte 91 Prozent. Fast die Hälfte dieser jungen Zielgruppe nutzt Instagram, TikTok und Co. heute intensiver als noch im Vorjahr. Doch ein Blick unter die Oberfläche offenbart Risse im digitalen Fundament – und die haben maßgeblich mit dem rasanten Einzug generativer künstlicher Intelligenz (KI) zu tun.

Das KI-Paradoxon: Große Kreationslust, massives Vertrauensproblem

Auf der Creator-Seite ist KI bereits Alltag. 22 Prozent der Befragten haben laut Deloitte schon Bilder per KI erstellt, jeder Zehnte generiert Videos oder Musik. Auch die Zahlungsbereitschaft ist überraschend hoch: Jeder Fünfte wäre bereit, monatlich über 10 Euro für entsprechende Tools auszugeben.

Auf der Konsument*innenseite jedoch kippt die Stimmung bedenklich. Zwei Drittel der Nutzer*innen geben an, dass sie KI-generierte Inhalte im Netz nicht mehr zuverlässig erkennen können. Schlimmer noch: 56 Prozent klagen über eine wachsende Flut an KI-generierten Postings „ohne Mehrwert“ – schlichtweg digitaler Spam. Die Konsequenz dieser Verunsicherung zeigt sich bereits in den Nutzungsdaten: Erste Altersgruppen, insbesondere Nutzer*innen ab Mitte 50, beginnen, ihren Social-Media-Konsum aktiv zurückzufahren.

Die Start-up-Perspektive: Die Zeiten des blinden KI-Hypes sind vorbei. Wer als Gründer*in heute rein quantitativ auf automatisierte Content-Erstellung setzt, riskiert Reichweite und Glaubwürdigkeit. Wie Deloitte-Expertin Sophie Pastowski anmerkt, braucht es dringend „transparente Kennzeichnung, um Vertrauen im digitalen Raum zu stärken.“ Genau hier entsteht ein massiver Zukunftsmarkt für „Trust-Tech“-Start-ups: Werkzeuge, die Authentizität verifizieren, Deepfakes zuverlässig herausfiltern, digitale Wasserzeichen etablieren oder Content-Provenance (Herkunftsnachweise) sichern, werden zu kritischen Erfolgsfaktoren für Plattformen und Verlage.

Streaming-Kollaps: Die Sehnsucht nach dem Super-Aggregator

Auch im Video-Streaming-Markt (SVoD) stehen die Zeichen auf Wandel. Der Markt ist in einer Reifephase angekommen: Zwar verbringen die Deutschen immer mehr Zeit mit Streaming, doch die Abo-Zahlen stagnieren. Mit durchschnittlich 2,5 Abos bei 64 Prozent der Haushalte ist die finanzielle und nervliche Schmerzgrenze offenbar erreicht.

Die Fragmentierung des Marktes wird zum Bumerang. Die Hälfte der Konsument*innen findet das zersplitterte Angebot unübersichtlich; das ständige Suchen nach Inhalten über verschiedene Apps hinweg („Decision Fatigue“) nervt. Das Resultat ist ein lauter Ruf nach Bündelung: 43 Prozent der Nutzer*innen wünschen sich eine plattformübergreifende Aggregation ihrer Dienste. Der Haken für Anbietende: 60 Prozent erwarten im Gegenzug für ein solches Bundle einen spürbaren Preisvorteil.

Die Start-up-Perspektive: Der Markt schreit nach einer funktionierenden Meta-Ebene. Wer es schafft, die zersplitterte Content-Landschaft in einer nutzer*innenfreundlichen Oberfläche (Super-App) mit intelligenter, plattformübergreifender Suchfunktion und klugem Pricing zu bündeln, trifft den absoluten Nerv der Zeit. Das reine Hinzufügen eines weiteren Nischen-Streamingdienstes dürfte es hingegen 2026 schwerer denn je haben.

Audio: Der harte Kampf um das knappe Gut „Glaubwürdigkeit“

Im Audio-Segment setzt sich der Strukturwandel fort. Podcasts boomen weiter und haben bei den 25- bis 34-Jährigen das klassische Radio bereits als wichtigstes Medium überholt. Doch das Radio verzeichnet mit 65 Prozent wöchentlicher Reichweite weiterhin eine enorme Resilienz. Der Grund ist ein entscheidender USP, von dem digitale Kanäle lernen können: Vertrauen. Wenn es um harte Informationen und die Nachrichtenlage geht, stufen 54 Prozent der Hörer das Radio als informativer und verlässlicher ein – Podcasts kommen hier nur auf 19 Prozent.

Fazit

Die Mediennutzung 2026 ist stark paradox geprägt: Technologie durchdringt die Erstellung von Inhalten immer tiefer, doch die Sehnsucht der Nutzer*innen nach Authentizität, Übersichtlichkeit und verlässlichen Quellen wächst proportional dazu. Für Start-ups bedeutet dies einen strategischen Paradigmenwechsel. Nicht das nächste Tool zur Erstellung von noch mehr billigem KI-Content ist der heilige Gral, sondern Lösungen, die in der Informationsflut Orientierung schaffen, Fragmentierung auflösen und echtes Vertrauen im digitalen Raum aufbauen. Wer diese Schmerzpunkte adressiert, hat im hart umkämpften Medienmarkt der kommenden Jahre exzellente Karten.

Selbstständigen-Report 2026: Wachsender Frust in der Gründer*innen-Szene

Der neue Selbstständigen-Report 2026 zeichnet das Bild einer demoralisierten Leistungsträger*innenschicht: Immer mehr Selbständige schätzen ihre wirtschaftliche Lage als prekär ein und fühlen sich von der Politik im Stich gelassen. Doch wer steckt hinter diesen alarmierenden Zahlen, und wie ist die Lage für Gründer*innen und Start-ups strategisch einzuordnen?

Herausgegeben wird der Report als Gemeinschaftsprojekt von WISO MeinBüro und dem Verband der Gründer und Selbstständigen Deutschland e.V. (VGSD). Die aktuelle Umfrage, an der sich zwischen Mitte Dezember 2025 und Mitte Februar 2026 insgesamt 2684 Personen beteiligten, zeigt die harte Realität der Solo-Selbständigen.