Aktuelle Events

Daniel Ek und die Spotify-Story

Neue Serie: Mega-Gründer und ihre Erfolgsgeheimnisse

Wie der Schwede Daniel Ek Spotify aufbaute und die Angriffe von Apple und der Musikindustrie kontert.

„Eigentlich habe ich mich nie als Entrepreneur gesehen, sondern als jemand, der viele interessante Probleme in der Welt erkennt, und fortwährend davon genervt ist, dass es hierfür noch keine Lösung gibt. Und dann habe ich festgestellt, dass es noch mehr Leute gibt, die diese Defizite als störend empfunden haben. Ok, habe ich gesagt, was machen wir also? Und nachdem sonst niemand diese Dinge angepackt hat, dachte ich: Dann muss ich das eben selbst angehen.“ So äußerte sich Daniel Ek in einem Gespräch mit KPCB-Venture-Capitalist Chi-Hua Chien an der Stanford University im Mai 2012.

Im Jahr 1997, Daniel war 14 Jahre, und hatte gerade seine erste Firma in Ragsved, einem Stockholmer Arbeitervorort, gestartet, verlangten Beratungsfirmen in Europa bis zu 50.000 Dollar, um eine Webseite zu programmieren. Daniel dachte sich: Das ist nun wirklich nicht so schwer, und begann Webseiten für seine ersten Kunden zu bauen. Seinen Mitschülern, die gut in Mathe waren, brachte er HTML bei und jenen, die gut zeichnen konnten, Photoshop. Am Ende war fast die ganze Klasse nach Unterrichtsschluss damit beschäftigt, Webseiten für Daniels Kunden zu entwickeln. „Ich habe das gar nicht so sehr als Firma betrachtet, ich wollte nur gute Ergebnisse erzielen“, sagt Daniel heute. Gleichzeitig hatte er das erste Mal in seinem Unternehmerleben das gute alte Tom-Sawyer-Prinzip angewandt: Das Anstreichen von Gartenzäunen nicht mehr als Arbeit darzustellen, sondern als Privileg. Man könnte auch sagen: Daniel hat auf höchstem Niveau delegiert.

Daniels Gründermarathon

Eks Eckdaten genügen für eine lebenslange Unternehmer-Biographie, aber das erste große Kapitel spielt sich in weniger als zehn Jahren ab: Nach seiner ersten Firmengründung mit 14 Jahren, verkaufte er seine Webagentur mit 19 und stieg – bereits Millionär – mit 21 als CTO bei Stardoll ein, einem heute noch verbreiteten Dress-Up-Game für Teenies, die hier ihre virtuellen Puppen ankleiden. Im Alter von 22 wurde Daniel CEO von uTorrent, einer Filesharing- und Streaming-Technologie, die auch von Piratenportalen genutzt wurde. Dazwischen fielen noch die Gründung und der Verkauf von Advertigo, einer Online-Marketing-Firma. Für rund 1,2 Millionen Dollar ging das Unternehmen an Tradedoubler, dessen CEO Martin Lorentzon später Daniels Co-Founder bei Spotify wurde. Nicht zu vergessen, da gab es noch Tradera, eine Auktionsplattform, die später von Ebay übernommen wurde.

Tech-Veteran mit 23 Jahren

Als Daniel sich mit 23 Jahren, das war 2006, an Spotify machte, war er bereits Multimillionär – und quasi ein Tech-Veteran mit knapp zehn Berufsjahren auf dem Buckel. Dem US-Musikmagazin Billboard erzählte er: „Ich war eigentlich noch ein Kind, ließ den Champagner fließen, fuhr schnelle Sportwagen und machte einen Haufen unanständige Dinge. Eines Morgens wachte ich auf, neben mir eine Frau – ich wusste nicht, wer sie war – und ich hatte nicht die geringste Erinnerung an die letzten drei Tage. Ich fühlte mich völlig leer.“

Daniel musste wieder runterkommen, fokussieren und zog in ein kleines Haus in der Nähe seiner Mutter, die ihn allein erzogen hatte, spielte Gitarre und plante seinen nächsten Schachzug. Seine Gedanken drehten sich um Napster, das er ja selbst nutzte, um Metallica-Tracks zu suchen und seinen ersten Led-Zeppelin-Song zu hören, „Kashmir“. Napster hatte ihn schon mit 14 Jahren fasziniert. Auf der einen Seite erkannte er, wie sich der Musikkonsum immer mehr in Richtung Piraterie verschob, und dass bereits eine halbe Milliarde Menschen weltweit illegal Musik hörten. Gleichzeitig sah er, dass die Musiker ums Überleben kämpften, und nicht mehr von ihrer Musik leben konnten. Apple verkaufte damals im iTunes-Store kopiergeschützte Musikfiles mit einer Qualität von 160 kBit/sek, während man zu PirateBay oder Kazaa gehen konnte, und hier die gleiche Datei fast ebenso schnell ohne Qualitätseinschränkung und ohne Kopierschutz herunterladen konnte. Also war klar, dass erstmalig ein Piratenprodukt dem legalen Produkt überlegen war. Kein Wunder, dass die Leute Piratenseiten nutzten.

Der Weg zu Spotify

Daniels Idee: Einen Musik-Service zu entwickeln, der mindestens so groß und bedienungsfreundlich wie Napster sein sollte, der aber legal betrieben werden sollte und der für die Übertragung der Rechte Geld an die Musikindustrie bezahlt. „Mein Ziel war es, mit Spotify einen Service zu bieten, der besser war als all die Piratenprodukte. Es sollte einfacher sein, Musik zu entdecken und zu teilen. Ich erkannte, dass wir mit einem derartigen Service die Chance hatten, rund 500 Millionen Menschen zu erreichen. Und zwar alle die, die Musik illegal konsumierten. Gleichzeitig war es das Ziel, wieder Wachstum in die Musikindustrie zu bringen und den Künstlern damit die Chance zu geben, weiter ihre Musik zu machen, die uns allen Freude macht. Ich wollte mit der Musikindustrie arbeiten, nicht gegen sie.“

Das aber erwies sich als extrem schwer. Daniels Freemium-Geschäftsmodell, das vorsah, sämtliche Musik dieser Welt legal und kostenlos zur Verfügung zu stellen, löste größte Bedenken bei den Managern der großen Plattenlabels wie Universal Music Group, Warner oder Sony aus. Vergeblich versprach Daniel Einnahmen über Werbefinanzierung zu generieren und kostenpflichtige Premium-Accounts zu verkaufen. Vergeblich versprach er vor allem, die angeschlagene Musikindustrie mit diesem Konzept wieder auf Wachstumskurs zu bringen. Das Trauma des Niedergangs und der Umsatzhalbierung der gesamten Sparte zwischen 1997 und 2005 in Folge der digitalen Veränderung war längst noch nicht verarbeitet, und Daniels Karriere bei uTorrent, dem Anbieter für illegale Streaming-Software, natürlich bekannt. Es musste so kommen: Daniel erhielt bei den großen Labels in New York zunächst eine Absage nach der anderen. „Ich war 25 und fühlte mich, als wäre mein Leben zu Ende“, erzählte er in einem Radio-Interview des schwedischen Rundfunks.

Dass er es doch schaffte, kann Daniel auch seiner Herkunft verdanken: Der Start in Schweden, einem vergleichsweise kleinen Musikmarkt, erwies sich als Vorteil für Spotify. Die schwedische Musikindustrie hatte nicht viel zu verlieren, war quasi am Boden durch die Piraterie, und so konnte Daniel seinen Proof of Concept in diesem kleinen Testmarkt erbringen, bevor er zunächst das übrige Europa und den US-Markt ins Visier nahm, Märkte in denen es für Spotify allerdings viel zu verlieren gab. Tatsächlich konnte der schwedische Musikmarkt, der infolge der Musikpiraterie praktisch tot war, ab ca. 2010 wieder zulegen, und sogar an die goldenen Zeiten vor 2001 anknüpfen. „Mehr und mehr andere Märkte wollten uns jetzt“ so Daniel.

Glücksfall Schweden – es gab noch weitere Gründe, die Daniel einen Standortvorteil einbrachten: Zum einen die starke Engineering-Tradition des Landes, zum anderen war der frühe Breitband-Ausbau der Netzinfrastruktur in Schweden ein wichtiger Faktor. Schon 2001 stand Daniel eine 100-Mbit-Download-Leitung zur Verfügung, also eine selbst nach heutigen Maßstäben hervorragende Infrastruktur. Dies inspirierte Daniel, er fragte sich: Wofür können wir dies nutzen? „Das Laden einer Webseite dauerte zwei Sekunden, also fingen wir an, größere Sachen zu laden, wie Videos und Musik, und das war neu.“

Eks Rezept: 95 Prozent Ausführung – 5 Prozent Idee

Was ist das Geheimnis, wenn man in komplexen „alten“ Branchen wie der Musikszene mit einem neuen Geschäftsmodell erfolgreich sein will? „Wenn ich von einer Sache überzeugt bin, gebe ich nie auf“, sagt Daniel. Ganz viel Geduld ist nötig, vor allem in Branchen, die von traditionellen Platzhirschen dominiert sind. Auch dass er all dies in so jungen Jahren gestartet hat, betrachtet Daniel heute als wesentlich für den Erfolg. „Ich war naiv, als ich Spotify startete. Zum Beispiel wusste ich am Anfang nicht, dass man zum Streamen Lizenzen von den Plattenfirmen brauchte, das habe ich erst später verstanden. Also sah ich nur die Lösungen, nicht die Schwierigkeiten auf dem Weg dahin, und dachte: Hey, das kann ja nicht so schwer sein. Leute mit entsprechender Erfahrung sagen über viele innovative Geschäftsideen, das funktioniert nicht, und zwar aus den Gründen XYZ. Tatsächlich aber stellt sich dann oft heraus, dass die meisten Sachen doch irgendwie möglich sind.“

Als Visionär oder Genie sieht sich Daniel dennoch nicht. „Immer wieder kommen Leute zu mir und fragen mich nach neuen Geschäftsideen, die sie umsetzen könnten, und ich sage: Ganz ehrlich, ich habe keine Ahnung, was funktionieren wird und was nicht, ich bin nicht der Prophet, der voraussagt, was der nächste große Erfolg sein wird.“ Zum Beispiel hatte Daniel um 2004 die Chance, sich bei Skype zu engagieren, doch er dachte, das wird nie was und lehnte ab. Überzeugt ist er allerdings, dass die Ausführung alles ist, die Ideen hingegen fast nichts. 95 Prozent Ausführung gegenüber fünf Prozent Idee, so beschreibt Daniel die Verhältnisse.

Rasantes Streaming-Wachstum

Was macht ein Software-Produkt gut, nach welchen Grundsätzen werden Anwendungen bei Spotify entwickelt? „Ich habe zwar als Techniker gestartet, aber bin wohl heute eher ein lausiger Programmierer. Aber ich denke lösungsorientiert“, sagt Daniel. „Das half mir.“ Daniel äußert sich, wie er Interfaces beurteilt: „Ich frage mich: Wozu ist es da? Was ist der Zweck des Interfaces? Und ich denke viel darüber nach, welches der kürzeste Weg von Punkt A nach Punkt B ist.“ Das zwingt zu Iterationen, zu Wiederholungsschleifen im Design und zu Tests. Bei Spotify sind es oft drei bis vier Versionen, die den Usern vorgelegt werden, bevor eine Entscheidung getroffen wird. Im Mittelpunkt steht die Frage: „Welches Problem will ich hier lösen, da muss man viel drüber nachdenken“, sagt Daniel.

Viele aktuelle Zahlen belegen, dass die meisten Überlegungen richtig waren. Der Wert von Spotify wird heute auf rund 8 Milliarden Dollar geschätzt. An den Standorten in neun Städten, u.a. London, New York und Stockholm, arbeiten knapp 1400 Leute und vor allem: Rund 75 Millionen Menschen in 58 Ländern nutzen den Streaming-Dienst, gut ein Viertel davon per kostenpflichtigem Abo zum Preis von 9,99 Dollar pro Monat. Von diesen Einnahmen sowie den Werbeerlösen aus den freien Accounts hat Spotify nach eigenen Angaben bislang mehr als drei Milliarden Dollar an die Musikindustrie ausbezahlt. Allein im ersten Jahresviertel 2015 betrugen demnach die Ausschüttungen für die Labels 300 Millionen Dollar.

Und so werden die Streaming-Umsätze für die Musikunternehmen immer wichtiger: Machten sie 2010 nur drei Prozent der globalen Gesamteinnahmen aus, stieg dieser Wert bis 2014 auf 15 Prozent. Gleichzeitig sank der Umsatz aus CD-Verkäufen von 54 Prozent auf 36 Prozent. Auch der Umsatz aus Downloads sinkt, wie eine Studie des Bundesverbands der Musikwirtschaft aus dem Jahr 2014 belegt. Hier heißt es: „Die Mutter des Digitalgeschäfts, der Downloadbereich, entwickelt sich tendenziell rückläufig.“ Streaming hingegen wächst rasant: In den letzten Wochen des Jahres 2014 wurden fast doppelt so viele Streams gezählt wie im Vergleichszeitraum des Vorjahres. Derzeit nutzen rund 11 Millionen Menschen in Deutschland Streamingdienste für ihren Musikkonsum, bis 2018 sollen es nach einer GfK-Studie 22 Millionen sein.

Schwarze Zahlen – Fehlanzeige!

Trotz glänzender Aussichten: Schwarze Zahlen hat Spotify noch nie geschrieben: Bei Einnahmen von rund 1,25 Milliarden Euro im Jahr 2014 verbuchte das Unternehmen 165 Millionen Euro Verlust. Und auch bei den Künstlern bleibt wenig Zählbares hängen: Pro Stream erhält ein Musiker im besten Fall nur 0,164 Cent ausbezahlt – dies rechnete der Hessische Rundfunk 2013 aus. Für ein gesamtes gestreamtes Album sind es zwei Cent, während die Erlöse für ein klassisch verkauftes Album durchaus drei Euro erreichen können. Das bedeutet: Das Album eines Künstlers muss etwa 150 Mal gestreamt werden, bis es Erlöse in der Höhe eines Verkaufs einspielt.

Manche Künstler spielen da nicht mehr mit. Prominentestes Beispiel ist die US-Sängerin Taylor Swift, Darling des amerikanischen Publikums, die ihr Portfolio Ende 2014 bei Spotify entfernen ließ: „Spotify feels to me like a grand experiment. I’m not willing to contribute my life’s work to an experiment that I don’t feel fairly compensates the writers, producers, artists and creators of this music.“ Das hat natürlich geschadet, mancher fragt sich: was bringt mir ein Streaming-Abo, wenn die aktuellen Hits nicht zu hören sind?

Ganz klar, Daniel Ek steht unter Druck. Der Typ, der immer in der Vorwärtsbewegung war, der die Musikbranche wie kein anderer zur Disruption zwang, der Offensivspieler im Strafraum dieser Industrie, er muss plötzlich Defensivaufgaben vor dem eigenen Tor übernehmen. Denn da wären noch mehr Fronten: Nicht nur die Künstler, auch die Musikindustrie macht Druck. Das Freemium-Modell ist vielen großen Playern ein Dorn im Auge. Und schließlich ist da seit Sommer 2015 ein noch mächtigerer Gegner, der mächtigste und reichste unserer Zeit: Apple mit seinem neuen Streaming-Dienst Apple Music.

Die mächtigen Spotify-Gegner

Keine Frage: Der Entrepreneur Daniel Ek muss sich neu beweisen. Nicht mehr Disruption, ganz andere Fähigkeiten sind gefragt. Wie macht er das, wird er das schaffen, und wenn ja, wie? Beginnen wir mit dem Problem Taylor Swift: Was schreibt Daniel Ek in seinem Blog? „Taylor Swift hat Recht. Musik ist Kunst, Kunst hat hohen Wert, und Künstler verdienen es, bezahlt zu werden. Wir starteten Spotify, weil wir Musik lieben und weil die Piraterie die Musik killte. Der Vorwurf, Spotify würde auf dem Rücken der Künstler Geld machen, regt mich auf.“ Und weiter, adressiert an alle Künstler: „Unser ganzes Business ist darauf ausgerichtet, den Wert Ihrer Musik zu maximieren.“ Dass Taylor Swifts Titel nach Löschung aus Spotify ganz oben in den Rankings von PirateBay und YouTube standen, war natürlich Daniels Killer-Argument zum Schluss dieser Apologie.

Nächstes Thema – die großen Player der Musikindustrie. Sony, Warner, UMG – sie alle halten mittlerweile ihre Anteile an Spotify, dank ihrer Verhandlungsposition als Rechteinhaber, kein Wunder. Doch das hindert sie nicht daran, Spotify offen in Frage zu stellen: Auf der Code/Media Konferenz im Frühjahr 2015 musste Spotify zwei vernichtende Urteile seiner wichtigsten Rechtelieferanten einstecken: Lucian Grainge, UMG-Chairman, sagte, auf lange Sicht sei das kostenlose, werbefinanzierte on-demand-Streaming nicht nachhaltig, und Sonys Music Entertainment CEO Doug Morris meinte gar: „In general, free is death.“

Freemium-Debatte und Börsengeflüster

Spotifys Umsätze aus Werbung sind nach wie vor gering, entsprechend auch die Tantiemen daraus für Labels und Künstler. Folglich drängen die großen Anbieter auf eine Beschneidung des Gratis-Services, etwa durch Drosselung von Qualität oder Nutzungszeit. Doch Spotify verteidigt das Freemium-Modell, in der Hoffnung Free-User noch zu Bezahl-Usern zu konvertieren. Daniels Entgegnung auf diesen Punkt: Die Freemium-Debatte gab es „von Anfang an. Glauben Sie, dass es künftig auch kein kostenloses Radio mehr gibt?“ Und dann kommt natürlich – gebetsmühlenartig – der Hinweis auf die Piraten, Daniels stärkste Waffe. Aber er hat noch ein anderes Ass im Ärmel: Den möglichen Börsengang von Spotify, über den immer wieder spekuliert wird. Vor allem seit Barry McCarthy im Sommer 2015 neuer Finanzvorstand von Spotify wurde, ein Spezialist für IPOs, der auch schon Netflix an die Börse gebracht hatte. Daniel weiß: Beim Börsengang wollen die großen Labels auch Kohle machen, ganz hart werden sie ihn vorher nicht fallen lassen.

Apple Music contra Spotify

Tja, und dann Apple. Apple Music, gelauncht Anfang Juli 2015, ist die Antwort auf sinkende Download-Zahlen in iTunes und auf den wachsenden Streaming-Markt. Es ist eine mächtige Replik. Denn auch Apples Streaming-Dienst bietet von Anfang an 30 Millionen Songs, ebenfalls zum Preis von 9,99 Dollar bzw. Euro pro Monat und für Familien sogar für nur 14,99 Dollar bzw. Euro. Die ersten drei Monate kann man kostenlos testen, ein Angebot, das nach einem Bericht der New York Post ca. 15 Millionen User weltweit angenommen haben und das für viele im Herbst 2015 ausläuft. Jetzt entscheidet es sich: Zwei bezahlte Streaming-Dienste parallel ergeben keinen Sinn, daher stellt sich die Frage: Gibt es eine Kündigungswelle für Spotify?

Letztlich stimmen die User ab, welche Plattform ihnen sympathischer ist. Apple kann eine Menge Argumente ins Feld führen: Spannend ist vor allem die kuratierte Musikauswahl, die sich genau an den Geschmack und die Hörgewohnheiten des Users anpasst. Außerdem: Die App ist auf Apple-Geräten vorhanden, man muss sie nicht mehr installieren, im Gegensatz zu Spotify. Doch Spotify besitzt einen ansehnlichen Vorsprung, und Jeff Levick, Chief Revenue Officer von Spotify, äußerte sich Anfang Oktober positiv, das gesteckte Ziel, nämlich 100 Millionen User, bis Ende 2015 zu erreichen.

Das ist auch die Haltung von Ek: Skandinavisch cool federt er den Angriff ab. Bereits legendär ist seine Reaktion auf Twitter zu Apple Music: „Oh, ok.“ Und auf der IAB MIXX Konferenz Anfang Oktober 2015 ergänzte er: „Für uns ist es wirklich großartig, dass Leute in diesen Bereich investieren, um die Musik nach vorn zu bringen, und dass wir nicht die einzigen sind, die sagen: Streaming ist die Zukunft.“ Und er fügte hinzu, dass es genug „Platz am Tisch gibt, weil das Streaming von Musik ganz am Anfang“ stehe. Außerdem, so Daniel in einem Videointerview mit Jason Calacanis: „Der einzige Weg in dieser sich schnell drehenden Welt zu gewinnen – und sie bewegt sich jeden Tag schneller, es gibt soviel Innovation weltweit – besteht darin, super-fokussiert auf ein bestimmtes Problem zu sein und das besser und schneller zu lösen als alle anderen.“ Allerdings: Dieses Statement steht in gewissem Widerspruch zu Daniels Aussage, am Tisch sei genug Platz für mehrere Anbieter ...

Spotify in allen Lebenslagen?

Zum Schluss der Ausblick, nur einige Details: Spotify setzt auf die Kombi Musik und Shows und bindet zunehmend Videos ein, dazu gehören auch Nachrichten, Unterhaltungsclips und Podcasts. Anwendungen wie Spotify Running wollen ein noch individuelleres Nutzererlebnis ermöglichen und machen Musikvorschläge, die sich genau dem Lauftempo des Users anpassen. Auch das Auto spielt bei Spotifys Plänen eine große Rolle. In Apple CarPlay und Android Auto ist Spotify bereits integriert. Nun kommt eine Kooperation mit Uber hinzu. Als Fahrgast hörte man bislang die Musik, die der Fahrer hörte. In Uber-Autos soll der Fahrgast mit Spotify-Account seinen eigenen Sound auflegen. Überhaupt, das ist Daniels Vision: Spotify soll für uns alle zum Bestandteil des täglichen Lebens werden. Wir werden mit Spannung verfolgen, ob Daniels Plan aufgeht und ob tatsächlich genug Platz am Tisch für alle ist.

Diese Artikel könnten Sie auch interessieren:

INLEAP Photonics: Wie ein Hannoveraner Spin-off die Drohnenabwehr der Zukunft mitgestalten will

Die asymmetrische Bedrohung durch unbemannte Flugsysteme zwingt Armeen weltweit zum technologischen Umdenken. Das 2023 gegründete DeepTech-Start-up INLEAP Photonics integriert seine laserbasierte Abwehrtechnologie nun erstmals auf ein unbemanntes Bodenfahrzeug. Eine Innovation, die das Potenzial hat, mobile Abwehrszenarien drastisch zu verändern – doch die Herausforderungen für die Gründer*innen im zähen Rüstungsmarkt sind enorm.

Mit dem neuen Systemformat verspricht INLEAP Photonics eine hochmobile und agile Antwort auf die Bedrohung durch Kleinstdrohnen. Die Fakten zur Plattform im Überblick:

- Die technologische Allianz: Das neueste System umfasst einen Lasereffektor, der auf einer kompakten, geländegängigen UGV-Plattform (Unmanned Ground Vehicle) von Hentschel System montiert wird. Hinzu kommt die C-UAS-Softwareplattform des Unternehmens STARK.

- Abwehr ohne Munition: Das System soll Drohnen der NATO-UAS-Klassen I und II gezielt neutralisieren.

- Geschwindigkeit und Präzision: Dies geschieht laut Unternehmensangaben in unter einer Sekunde, völlig ohne Munition und Kollateralschäden.

Wie aber löst man physikalisch die extreme Herausforderung, einen Laser auf einem über unebenes Gelände fahrenden Roboter so zu stabilisieren, dass er sein Ziel in Sekundenbruchteilen erfasst? „Wir reden weniger von einer Zielerfassung in unter einer Sekunde, sondern von einer präzisen und sehr schnellen Neutralisierung der Drohne“, korrigiert CEO und Mitgründer Dr.-Ing. Marius Lammers.

Der Trick der Hannoveraner: Sie setzen nicht einfach einen gewöhnlichen Laser auf ein Auto und verzichten gänzlich auf träge, mechanisch verkippte Bauteile. „Unsere Technologie basiert auf ultraschneller, pixelbasierter Laserstrahllenkung“, erklärt Lammers. Die nötige Stabilisierung in rauem Terrain entstehe durch das clevere Zusammenspiel aus Sensorik, Plattformdaten und der eigenen Steuerungstechnik. „Gerade weil wir aus industriellen Hochpräzisionsanwendungen kommen, in denen Optik, Maschinenbau und Prozessstabilität unter anspruchsvollen Bedingungen zusammenkommen müssen, können wir diese Robustheit auf mobile Szenarien übertragen“, betont der Gründer.

Premiere vor der Militärspitze & Gründungshistorie

Vorgestellt wurde die Lösung erstmals am 12. Mai 2026 auf der Technologieshow des Innovationszentrums der Bundeswehr auf dem Fliegerhorst Erding. Dort präsentierten Lammers und sein CTO Dr.-Ing. Felix Wellmann das System hochrangigen Offizieren, darunter Heeresinspekteur Generalleutnant Christian Freuding und Flottillenadmiral Christian Bock. Damit trifft das 2023 aus dem Laser Zentrum Hannover e.V. (LZH) ausgegründete Start-up exakt den Nerv der Truppe, die händeringend nach äußerst flexiblen, einsatzreifen C-UAS-Systemen sucht. Komplettiert wird das exist-geförderte Kernteam durch CFO Katharina Haas, die mit dem Unternehmen unlängst den 2. Platz beim „Digitalen Start-up des Jahres 2025“ des Bundeswirtschaftsministeriums holte.

Doch wie schwer fiel dem akademischen Spin-off der Schritt in die wehrtechnische Industrie? Für das Team sei dies eine logische Konsequenz der aktuellen Sicherheitsarchitektur gewesen, räumt Lammers ein. „Kleine Drohnen sind heute keine abstrakte Zukunftsbedrohung mehr. Sie sind ein reales Problem“, stellt er klar. Den Fokus auf wehrtechnische Lösungen sehe man nicht als Verrat an den zivilen Wurzeln, sondern als „verantwortungsvolle Erweiterung“ einer industriell entwickelten Technologie.

Gleichwohl verlangt der Rüstungsmarkt Antworten auf heikle ethische Fragen. INLEAP setze deshalb auf das „Human-in-the-Loop“-Prinzip, um Risiken im Einsatzumfeld zu minimieren. „Am Ende geht es für uns darum, Menschen, Infrastruktur und Einsatzfähigkeit wirksam zu schützen“, so der CEO. Flankiert wird dies von einem konsequenten Dual-Use-Ansatz: Neben der Drohnenabwehr optimiert das Start-up weiterhin industrielle Fertigungsprozesse, was im August 2025 mit einer millionenschweren Pre-Seed-Finanzierung durch den High-Tech Gründerfonds (HTGF) belohnt wurde.

Markt & Wettbewerb

Der Markt für C-UAS explodiert, denn die kleinen Fluggeräte attackieren längst nicht mehr nur stationäre Ziele, sondern auch mobile Einheiten. In diesem lukrativen Umfeld forschen Branchenriesen wie Rheinmetall oder Lockheed Martin mit gewaltigen Budgets an Hochenergielasern.

Auf die Frage, wo angesichts dieser Übermacht der eigene technologische Schutzwall liegt, gibt sich Lammers selbstbewusst: „Ein Unternehmen, das jahrelang ballistische Systeme gebaut hat, kann nicht von heute auf morgen sagen: ,Jetzt machen wir Laser.‘ Das funktioniert nicht.“ Lasertechnik sei eine völlig eigene Disziplin, die sich nicht einfach durch hohe Budgets einkaufen lasse.

Der eigentliche „Burggraben“ der Hannoveraner sei die Herkunft ihrer Innovation: Die extrem schnelle Laserstrahllenkung wurde nicht als Waffensystem, sondern für zivile Hochpräzisionsprozesse entwickelt. Während klassische Hochenergielaser der Großkonzerne zudem oft an Grenzen bei der Augensicherheit oder der schieren Systemgröße stoßen, setze INLEAP genau hier an. „Große Unternehmen haben Ressourcen; wir haben Geschwindigkeit, eine sehr spezifische Optik-Expertise und eine Technologie, die nicht aus einem klassischen Waffensystem heraus gedacht wurde“, kontert der Gründer.

Das Geschäftsmodell auf dem Prüfstand

Trotz aller technologischer Euphorie stehen Hardware-Start-ups im DefenseTech-Sektor oft vor dem berüchtigten „Tal des Todes“ – die Beschaffungszyklen des Militärs sind quälend lang.

Fragt man Lammers konkret nach der aktuellen Burn-Rate und ob das Funding wirklich bis zu einem echten Serienauftrag der Bundeswehr reicht, mauert der CEO. Zu internen Finanzkennzahlen äußere man sich nicht im Detail, diese seien ohne den Kontext der Finanzierungsstrategie „ohnehin wenig aussagekräftig“. Stattdessen verweist er auf die breite Aufstellung des Unternehmens. Man hänge nicht an einem einzigen Beschaffungspfad. „Außerdem denken wir das Geschäftsmodell nicht nur über Hardwareverkäufe, sondern auch über Service, Wartung, Software-Updates und kundenspezifische Integration“, weicht Lammers den finanziellen Bedenken aus.

Die jüngste HTGF-Finanzierung sowie starke Partner sollen das Überleben sichern. Die Kooperationen mit STARK und Hentschel System würden Integrations- und Marktzugänge deutlich beschleunigen. Das zivile Industriegeschäft bleibt hierbei als essenzielles zweites Standbein bestehen, um Cashflows zu generieren.

Dual-Use als neuer Goldstandard

Noch vor wenigen Jahren hätten sich deutsche VCs bei militärischen Systemen stark zurückgehalten, heute ist DefenseTech hochattraktiv. Doch der Zeitplan der Bundeswehr ist ambitioniert: Im dritten Quartal 2026 soll die Erprobung in einem Bündnisverteidigungsszenario starten, bereits ab 2027 wird die Lieferung erwartet.

Kann ein so junges Start-up aus dem Stand die Produktionskapazitäten für eine Serienfertigung hochfahren? „Ja, die Serienproduktion ab 2027 ist unser klares Ziel“, verspricht Lammers. Der Schlüssel für die Skalierung liege erneut in den Partnerschaften: „Wir müssen nicht jede Komponente selbst neu entwickeln, sondern können unseren Lasereffektor in ein Gesamtsystem einbringen.“ Nach den geplanten Tests sollen erste einsatznahe Systeme ausgeliefert, Feedback evaluiert und die Produktion „kontrolliert hochgefahren“ werden.

Das Team aus Hannover demonstriert eindrucksvoll, wie wissenschaftliche Exzellenz direkt in geostrategisch relevante Hardware übersetzt werden kann. Meistert INLEAP Photonics die kommenden Erprobungsphasen und skaliert die Produktion, könnte das Unternehmen schon bald zu einem neuen DeepTech-Leuchtturm Deutschlands avancieren. Ob die Hannoveraner ihr ambitioniertes Versprechen in den harten Feldtests der Bundeswehr wirklich einlösen können, müssen die kommenden Monate erst noch beweisen.

SportTech-Start-up-Report 2026

Der Hype ist tot, die KI übernimmt: Wie DeepTech den SportTech-Markt 2026 dominiert – und welche deutschen Start-ups das Milliarden-Rennen machen.

Der Geruch von Rasen weicht zunehmend dem leisen Surren von Hochleistungsservern. Wer im Jahr 2026 an die Sportindustrie denkt, darf nicht mehr nur an überfüllte Stadien und verschwitzte Trikots denken, sondern muss Algorithmen, Drohnen und neuronale Netze vor Augen haben. Die Transformation der SportTech- und E-Sports-Branche hat endgültig den Sprung vom verspielten Nischenthema zum essenziellen Wirtschaftsfaktor geschafft – doch der Weg dorthin war ein brutaler Ausleseprozess. Wo vor wenigen Jahren noch blind Millionen in naive Krypto-Träume, überteuerte Fitness-Gadgets und kurzlebige Influencer-Ligen gepumpt wurden, ist nach einer beispiellosen Welle spektakulärer Start-up-Pleiten nun knallharter Realismus eingekehrt.

Der Markt hat sich radikal bereinigt: Heute werten hochkomplexe, KI-basierte digitale Coaches die Biomechanik von Athlet*innen in Echtzeit aus. Physischer Spitzensport und digitale Welten verschmelzen in hybriden Ligen, während Augmented Reality das Fan-Erlebnis im heimischen Wohnzimmer neu definiert. Es ist ein Milliardenmarkt entstanden, der klassische Vereinsstrukturen aufbricht und Gründer*innen eine erbarmungslose Arena bietet: Der Hype ist tot, es überleben nur noch Start-ups mit echter technologischer Substanz.

Die Marktlage: Milliarden-Wetten auf die digitale Athletik

Der Markt für Sporttechnologie und E-Sports hat seine post-pandemische Findungsphase längst hinter sich gelassen und präsentiert sich so reif und kapitalstark wie nie zuvor. Ein Blick auf die realen Marktdynamiken genügt: Branchenspezifische Analysen internationaler Tech-M&A-Berater*innen belegen das kontinuierliche Wachstum des globalen SportsTech-Marktes. Parallel dazu zeigen die fundierten Erhebungen des Bitkom und des KfW Research zum allgemeinen Start-up-Ökosystem unmissverständlich, dass Wagniskapital heute primär in DeepTech fließt.

Der absolute technologische Haupttreiber des Sektors ist die angewandte künstliche Intelligenz, dicht gefolgt von Spatial Computing. Während der Krypto- und Blockchain-Hype der frühen 2020er Jahre einer harten Marktkorrektur gewichen ist, dominieren nun handfeste B2B-SaaS-Lösungen und KI-gestützte Computer-Vision-Modelle das Feld. Die Unit Economics haben sich branchenweit stabilisiert. Investor*innen vergeben wieder signifikante Runden an Start-ups, die nachweislich die Leistung von Athleten steigern oder die Monetarisierung von Fan-Daten messbar optimieren können – und zwar ohne dabei in die hochriskante und teure Hardware-Falle zu tappen.

Die neuen Treiber (Sub-Sektoren): Vom Feld direkt in die Cloud

Wer heute noch versucht, eine weitere reine Fitness-Community-App zu bauen, erntet in den Boardrooms der VCs nur noch ein müdes Lächeln. Der Markt wird von hochspezifischen Sub-Sektoren getrieben, die tief in die Wertschöpfungskette des Sports eingreifen. Der dominierende Bereich ist „Markerless Computer Vision“, bei dem Kameras ohne am Körper getragene Sensoren jede Bewegung präzise erfassen und KI-Modelle Verletzungsrisiken prädiktiv berechnen.

Ein weiterer explosiver Treiber ist das „Immersive Fan Engagement“, wo Spatial Audio und Augmented Reality Stadionbesuche für globale Fans virtuell erlebbar machen.

Schließlich dominiert der „Hybride E-Sport“, bei dem physische Leistung nahtlos mit In-Game-Mechaniken verknüpft wird. Etablierte Pioniere wie das Münchner Vorzeige-Unternehmen Kinexon, das mit seiner präzisen Tracking-Hardware und Taktik-Software längst die NBA und Bundesliga erobert hat und branchenintern als heißer Anwärter auf den Unicorn-Status gehandelt wird, haben hierfür den Weg geebnet und gezeigt, dass deutsche DeepTech-Lösungen globale Standards setzen können.

Reality Check: Der teure Spiegel der Wahrheit

Doch der Weg in den Sport-Olymp ist gepflastert mit den Ruinen überhypter Geschäftsmodelle. Das einst prominenteste Mahnmal ist der tiefe Fall von Connected-Fitness-Hardware-Anbietern wie VAHA. Der smarte Fitness-Spiegel aus Berlin scheiterte an der Post-Covid-Realität und wurde Ende 2022 im Rahmen eines Fire-Sales veräußert. Ebenso zerschellten Krypto-Träume an der harten Marktwirklichkeit: Das Münchner Start-up The Football Club (TFC), gegründet 2020, das den Fußballfandom mit NFT-Avataren revolutionieren wollte, ging bereits 2023 nach dem Platzen der Blockchain-Blase in die Insolvenz.

Fast zeitgleich musste mit Coachinho (Gründung 2021) ein weiteres ambitioniertes Software-Projekt die Segel streichen: Die KI-basierte Pose-Detection-App für Amateurkicker versprach digitale Profi-Expertise via Smartphone-Kamera, ging jedoch trotz Unterstützung der NRW.Bank Ende 2023 in die Knie – der Spagat zwischen komplexer Computer-Vision-Technologie und einer nachhaltigen Monetarisierung im Breitensport erwies sich als zu groß.

Zwei brandaktuelle Dramen erschütterten die Branche jedoch erst kürzlich. Zum einen musste das Jenaer Start-up Coachwhisperer (Gründung 2021) im Frühjahr 2026 zum Amtsgericht – die brutalen Entwicklungskosten ihrer In-Ear-Hardware hatten Millionen verschlungen. Zum anderen endete der gewaltige Hype der Kölner Baller League (Gründung 2023). Das hybride Medienunternehmen mischte den Markt durch Twitch-Kultur und Influencer zunächst radikal auf, doch nachdem Hauptsponsoren wie XING absprangen und Prominente sich zurückzogen, musste der deutsche Ligabetrieb im Januar 2026 eingestellt werden.

Aus solchen Crashs lassen sich vier fatale Fallstricke ableiten:

- Die Hardware-Falle. Wer auf physische Geräte setzt (wie VAHA oder Coachwhisperer), unterschätzt die Komplexität und Kapitalintensität der Produktion.

- Die toxischen Customer Acquisition Costs. Im B2C-Geschäft und bei reinen Hype-Formaten explodieren Marketing- und Influencer-Ausgaben so schnell, dass sie jegliche Margen auffressen.

- Die Churn-Rate-Illusion. Wenn der anfängliche Hype verfliegt (wie bei TFC oder der Baller League), kündigen Nutzer*innen Abos und Sponsoren springen ab.

- Der regulatorische und technologische Blindflug. Wer – wie Coachinho – biomechanische Daten per Kamera verarbeitet, scheitert in Europa nicht nur an der extremen technologischen Hürde, sondern oft auch an den strengen DSGVO-Vorgaben, wenn Privacy-by-Design nicht vom ersten Tag an verankert ist.

Das deutsche Netzwerk (Hotspots)

Die deutsche Szene konzentriert sich auf hochspezialisierte urbane Hubs, die eine perfekte Symbiose aus Forschung, Kapital und Industrie bieten. München thront dank der Technischen Universität (TUM) und der Innovationsmaschinerie der UnternehmerTUM unangefochten an der Spitze, wenn es um DeepTech, Sensortechnik und Wearables geht. Berlin bleibt das unbestrittene Epizentrum für E-Sports und Fan-Engagement, angetrieben durch die Präsenz globaler Player wie Riot Games, Mega-Organisationen wie G2 Esports und ein dichtes Netz an Kreativagenturen. Köln hat seine historische Stärke als Sitz der Deutschen Sporthochschule (DSHS) sowie der ESL genutzt, um sich als europäischer Hotspot für sportwissenschaftliche Start-ups und Live-Event-Technologien zu etablieren. Leipzig komplettiert das Quartett; angetrieben durch den SpinLab Accelerator hat sich die Stadt eine exzellente Nische im Bereich E-Health, Reha-Technologien und digitaler Prävention im Spitzensport erarbeitet.

Investor*innen-Radar

Das Kapital fließt aus hochspezialisierten Quellen. Bei den dedizierten VCs führt global kein Weg an BITKRAFT Ventures vorbei; der Fonds mit starken Berliner Wurzeln ist der absolute Königsmacher im E-Sports- und Web3-Gaming-Segment. Ergänzt wird dies durch Spezialisten wie leAD Sports & Health Tech Partners, die gezielt Frühphasen-Start-ups skalieren. Auch die Top-Tier Generalisten haben Blut geleckt: Earlybird und Cherry Ventures platzieren zunehmend Wetten auf B2B-SaaS-Modelle, die Sportdaten monetarisieren. Auf industrieller Seite dominieren Corporate VCs wie Porsche Ventures, die in Performance-Tech investieren, sowie Adidas, die nach digitalen Fitness-Ökosystemen suchen. Der wahre Motor der Frühphase sind jedoch erfahrene Business Angels. Prominente Köpfe aus dem echten Sport wie Mario Götze, Julian Draxler oder Oliver Bierhoff haben sich längst als smarte Co-Investoren etabliert, die nicht nur Kapital, sondern unbezahlbaren Zugang zu Vereinen und Athlet*innen mitbringen.

Die Top Start-ups (Must-Watch)

Für die Auswahl der Top-Start-ups in diesem Report haben wir strenge Kriterien angelegt. Alle beleuchteten Unternehmen sind ausschließlich deutsche Start-ups, deren Gründung im Jahr 2020 oder später erfolgte. Wir bewerten nicht nach den lautesten Marketing-Kampagnen, sondern nach vier harten Metriken: belegbare Marktrelevanz, die Tiefe der technologischen Innovation (Reifegrad), Diversität in den Geschäftsmodellen und Gründungsteams sowie das nachgewiesene Vertrauen hochkarätiger Investor*innen. Zudem floss die Skalierbarkeit des jeweiligen Ansatzes maßgeblich in die finale Bewertung ein.

Prematch (Gründung 2021)

Das Kölner Gründer-Trio Lukas Röhle, Fiete Grünter und Niklas Brackmann hat mit Prematch den „Transfermarkt für den Amateurfußball“ erschaffen. Das B2C- und B2B-Plattform-Modell bündelt Spieldaten, News und Statistiken bis in die tiefsten Amateurligen. Der USP liegt in der gigantischen, hochaktiven Basisdaten-Sammlung, die auch für Werbetreibende extrem wertvoll ist. Zuletzt flossen Millionen in mehreren Runden, angeführt von namhaften Business Angels: Neben den Profis Serge Gnabry und David Raum stieg auch das Family Office von Jürgen Klopp sowie Weltmeister Toni Kroos als strategischer Investor ein.

Dyn Media (Gründung 2022)

Unter der Vision des ehemaligen DFL-Chefs Christian Seifert und der operativen Führung von CEO Andreas Heyden revolutioniert Dyn Media als B2C-Streaming-Plattform die Sichtbarkeit von Sportarten jenseits des Fußballs. Der technologische USP liegt in einer hochmodernen, Cloud- und KI-gestützten Produktionsinfrastruktur, die Übertragungskosten drastisch senkt. Als absoluter Vertrauensbeweis der Branche gilt das starke Fundament des Medienprojekts: Das Joint Venture mit dem Medienriesen Axel Springer sichert der Plattform langfristig die nötige Finanzkraft und eine enorme mediale Reichweite.

Exakt Health (Gründung 2021)

Das von Philip Billaudelle und Lucia Payo in Berlin gegründete Start-up Exakt Health liefert den perfekten Gegenentwurf zur überhypten Fitness-Hardware. Das B2C-SaaS-Modell ist als echtes, zertifiziertes Medizinprodukt (MDR) zugelassen und bietet eine physiotherapeutische App für Sportverletzungen. Der USP liegt in den adaptiven, KI-gestützten Trainings- und Rehaplänen, die auf strengen medizinischen Leitlinien basieren. Dieses tiefe technologische Fundament sicherte dem Team Millionen-Investments von starken Lead-Investoren wie der Barmenia Next Strategies sowie von erfahrenen Engeln wie dem N26-Gründer Maximilian Tayenthal.

Enduco (Gründung 2020 / Neustart 2024)

Die Geschichte von Enduco ist die ultimative „Phönix aus der Asche“-Story der Szene. Ursprünglich 2020 gegründet und vom High-Tech Gründerfonds (HTGF) finanziert, musste die GmbH Mitte 2024 Insolvenz anmelden. Doch statt aufzugeben, formierte das Team um Mitgründer Lennard Schäfer das B2C-SaaS-Modell unter dem neuen Firmendach der endurance coach GmbH radikal neu. Die App bietet Ausdauersportlern eine Trainingsplanung, die mithilfe von maschinellem Lernen auf Vitaldaten reagiert – ein handfester Beweis, dass echte technologische Substanz harte Unternehmenskrisen überdauern kann.

Internationaler Ausblick & Fazit

Wer den Blick über den europäischen Tellerrand wagt, erkennt drei globale Makro-Trends, die den deutschen Markt in Kürze mit voller Wucht treffen werden. Aus den USA schwappt die Welle des „Markerless Tracking“ herüber, bei dem reine Smartphone-Kameras genügen, um durch komplexe KI-Berechnungen vollständige biomechanische Profile zu erstellen – der Anfang vom Ende der klobigen Wearables. Asien dominiert derweil die Entwicklung von KI-generierten Live-Kommentatoren und hyperrealistischen Avataren, die E-Sports-Übertragungen in dutzenden Sprachen gleichzeitig und vollautomatisiert moderieren. Aus dem DeepTech-Hub Israel drängen Start-ups auf den Markt, die neurokognitives Bio-Feedback nutzen, um die Reaktionszeiten von Profisportlern durch Gehirnstrom-Analysen messbar zu verkürzen.

Das Fazit für Gründer*innen und Investor*innen: Bunte Community-Apps ohne echten technologischen Burggraben haben in der SportTech-Branche keine Überlebenschance mehr. Gewinnen wird, wer harte DeepTech-Lösungen im B2B-Bereich etabliert, echte Leistungsprobleme durch Daten löst und verstanden hat, dass der Sport der Zukunft im Code entschieden wird.

Marlow: Kein Führerschein, aber das Auto neu gedacht

Die Gründer Florian Ritzel und Jannik Kirchhoff aus Hamburg wollen das Problem der versteckten Autokosten lösen. Ihre App Fahrfuchs* kletterte ohne Marketingbudget in die Top 100 der Finanz-Charts im App Store – eine klassische Bootstrapping-Erfolgsgeschichte. Doch wie tragfähig ist das Geschäftsmodell, wenn etablierte Konkurrenten den Markt beherrschen?

* Hinweis der Redaktion (29.05.26): Aufgrund eines Copyright-Streits mussten die Gründer ihre App umbenennen – diese heißt jetzt Marlow statt Fahrfuchs.

Während andere Abiturient*innen für Klausuren büffeln, programmierten Florian Ritzel und sein Mitgründer Jannik Kirchhoff (beide 18) ein Start-up. Die Initialzündung war laut den beiden Hamburger Gymnasiasten eine gesellschaftliche Beobachtung: Die Belastung durch Mobilitätskosten. „Die alleinerziehende Mutter sollte nicht an der Zapfsäule stehen müssen und entscheiden, ob sie ihr Kind in die Kita oder sich selbst zur Arbeit fährt“, beschreibt Ritzel die Motivation hinter dem Projekt. Die amüsante Ironie ihrer Gründung: Die Marlow-Gründer besitzen aktuell nicht einmal einen Führerschein.

Auf die naheliegende Skepsis bezüglich dieses fehlenden „Nutzer-Wissens“ reagiert Florian Ritzel offensiv: „Natürlich gibt es immer Leute, die unsere Idee kritisieren. Und fehlendes Nutzerwissen ist gerade am Anfang schwierig, vor allem, wenn man eine App bauen möchte, die möglichst vielen Menschen hilft.“ Doch aus der vermeintlichen Schwäche machten sie eine Stärke durch maximale Nutzerorientierung. „Wir haben bereits vorher im Umfeld rumgefragt, was die Leute eigentlich brauchen, und danach gezielt um Feedback gebeten“, erklärt der Gründer. Der Erfolg gibt ihnen recht: „Inzwischen erreichen uns täglich dutzende Mails mit Tipps – was die Nutzer*innen sich wünschen und wie wir die App verbessern können. Dadurch wird uns das Ganze nicht zum Verhängnis, sondern sogar zum Vorteil.“

Mit Marlow wollen sie den rund 48,5 Millionen Pkw-Halter*innen in Deutschland auf den Cent genau aufzeigen, wo das Auto wirklich Geld frisst. Denn der teure Kraftstoff ist nur ein Teil der Wahrheit. Falsche Versicherungstarife, unbemerkter Wertverlust, Wartung und vergessene Pendlerpauschalen reißen oft weitaus größere Löcher ins Budget. Die Resonanz ist für die frühe Phase beachtlich: Ganz ohne bezahltes Marketing sammelte die App schnell über 700 Downloads ein – eine für den Massenmarkt zwar noch bescheidene Zahl, die jedoch ausreichte, um mehrfach in die Top 100 der Finanz-Charts im App Store zu stürmen. Zudem generierte das Projekt rein organisch Presseberichte, unter anderem in der FAZ, der SWP und bei Antenne Bayern.

Holistischer Ansatz statt reiner Tank-App

Auf den ersten Blick wirkt Marlow wie ein weiterer Spritpreis-Radar. Die App zieht in Echtzeit Daten der Markttransparenzstelle für Kraftstoffe, listet Ladesäulen für E-Autos und alarmiert per Push-Nachricht bei günstigen Preisen. Der entscheidende Pivot ist jedoch das ganzheitliche Kostentracking: Die Gründer haben einen eigenen Versicherungsrechner sowie einen Steuer-Sparrechner integriert, bieten detaillierte Monatsreports an und binden die Nutzer*innen über einen Gamification-Ansatz („Sparfuchs-Score“). Ein zentrales Versprechen in Zeiten von Datenskandalen: Alle sensiblen Nutzer*innendaten werden lokal auf dem Endgerät gespeichert – es gibt keine zentrale Cloud.

Angesprochen auf die Skalierbarkeit dieses Modells bezieht Jannik Kirchhoff klar Stellung: „Die lokale Datenspeicherung ist gerade in Deutschland kein strategisches Eigentor. Ich halte nichts für wichtiger, als die privaten Daten unserer Nutzer*innen zu schützen“. Er warnt vor den Risiken zentraler Speicherlösungen: „Niemand muss wissen, wo ich wohne, wohin ich morgens fahre oder wo meine Kinder zur Kita gehen. Wir haben in der Vergangenheit immer wieder gesehen, dass jeder gehackt werden kann. Und gerade als junge Entwickler können und wollen wir diese Verantwortung nicht übernehmen“. Personalisierte Spar-Vorschläge ließen sich laut Kirchhoff auch direkt auf dem Smartphone „hervorragend realisieren“.

Ein echtes Haifischbecken

Die Vision ist ambitioniert, doch der Markt ist hart umkämpft. Die Konkurrenz reicht von Excel-Tabellen bis zu Platzhirschen wie Spritmonitor oder Giganten wie Clever Tanken. Warum also wechseln? Florian Ritzel gibt sich selbstbewusst: „Die Spritpreis-Übersicht ist bei uns nur eines von vielen Features – nicht der Hauptteil. Wer Spritmonitor so gut findet, darf dort gerne bleiben.“ Der Fokus liege woanders: „Wer aber wirklich tracken möchte, was sein Auto insgesamt kostet, der kann das eben nur bei uns. Diese Gesamtheit an Features gibt es bisher in keiner anderen App in dieser Form.“ Selbst das Argument der manuellen Excel-Tabelle lässt er nicht gelten: „Natürlich kann man sich das selbst in Excel bauen – aber darauf haben die meisten Leute schlicht keine Lust. Genau deswegen sind wir so gut.“

Kritisch hinterfragt

Trotz des Aufklärungscharakters ist Marlow kein reines Hobbyprojekt; In-App-Käufe für eine „Plus“-Version (0,99 €/Monat) sowie eine „Pro“-Version (2,99 €/Monat bzw. 19,99 €/Jahr) bilden das Monetarisierungsmodell. Ob die selbstgestrickte Mathematik hinter dem Versicherungsrechner, der auf hunderten per Hand durchgerechneten Profilen basiert, ohne echte API-Schnittstellen dauerhaft standhält, bleibt abzuwarten.

Wie viele Abonnent*innen braucht es, um nach dem Abitur davon zu leben? Jannik Kirchhoff rechnet vor: „Ehrlicherweise vermutlich mehr als 10.000 zahlende Abonnent*innen – aber das ist zunächst auch nicht unser Ziel.“ Aktuell stehe das Lernen im Vordergrund: „Wir wollen vor allem Erfahrungen sammeln durch das, was wir machen, und gleichzeitig die laufenden Kosten decken. Das sollte demnächst möglich sein.“

Für die Zeit nach dem Abschluss hält er sich alle Türen offen: „Risikokapital halte ich ab dem Moment für unumgänglich, an dem wir wirklich konkret expandieren wollen. Das wird vermutlich nach dem Abitur der Fall sein. Dann muss man schauen, ob es sich lohnt, Anteile abzugeben oder Kredite aufzunehmen.“ Sein Fazit: „Spannend wird es erst, wenn wir die Idee wirklich groß skalieren wollen.“

Ein exzellentes MVP mit Pivot-Potenzial

Marlow ist ein Lehrbuchbeispiel für ein hervorragendes Minimum Viable Product (MVP). Um jedoch hochprofitabel zu werden, könnte mittelfristig ein Wechsel hin zur Affiliate-Provision für Versicherungswechsel nötig sein. Doch hier bremst Florian Ritzel bewusst: „Versicherungspartner wollen wir zunächst bewusst nicht werden, denn einer der entscheidendsten Punkte unserer App ist, dass wir Versicherungsdaten unabhängig zur Verfügung stellen.“

Sein Ziel ist technologische Exzellenz: „Meilenstein eins ist, den Versicherungsrechner so akkurat zu machen, dass wir auf Check24-Niveau sind – ohne dafür Provisionen zu kassieren.“ Zudem plane man Kooperationen mit Fahrschulen und Werkstätten, um die Leute genau dort zu erreichen, „wo sie am meisten ans Auto denken“. Die größte Hürde bleibt derweil technischer Natur: „Meilenstein drei ist die Android-Version – das ist allerdings extrem schwer umzusetzen, gerade wenn man iOS-Coding gewohnt ist.“ Dennoch verspricht er: „Wir planen das aber innerhalb der nächsten drei Monate.“

Der Grundstein ist gelegt. Nun müssen die beiden Hamburger beweisen, dass sie nach dem Abitur nicht nur programmieren, sondern auch unternehmerisch durch den dichten Verkehr des Mobilitätsmarktes navigieren können.

Von der Risikoanalyse zur echten Rendite: Wie Resilens den Markt für Klimaanpassung knacken will

Ein zu erwartender Hitzesommer reiht sich nahtlos an den nächsten, und die spürbaren Klimarisiken für Städte, Institutionen und Unternehmen wachsen rasant. Doch während die Investitionsbedarfe steigen, gerät die Umsetzung oft ins Stocken: Es fehlen bislang effiziente Verfahren, um abstrakte Gefahren in finanzierbare Investitionspläne zu übersetzen. Genau an diesem Flaschenhals setzt die neue Plattform Resilens an. Das 2026 von Dr. Oliver Marchand, Stephan Heuel und Christian Schmelter gegründete schweizerisch-deutsche Start-up verspricht nicht weniger als den Paradigmenwechsel vom reinen Klimarisiko hin zum messbaren „AdaptationReturn“. Wir nehmen das Geschäftsmodell, die Köpfe dahinter und die Hürden des Unternehmens unter die Lupe.

Die Macher hinter der Resilens UG sind in der europäischen ClimateTech-Szene keine Unbekannten. CEO und Mitgründer Dr. Oliver Marchand hat mit seinem vorherigen Start-up Carbon Delta – das 2019 erfolgreich vom Finanzdienstleister MSCI übernommen wurde – bereits bewiesen, wie man wissenschaftlich fundierte Klimamodelle kommerzialisiert. Das Team vereint gezielt Technologie und Vertrieb: Neben Marchand treiben Stephan Heuel als CTO und Christian Schmelter als CCO die Entwicklung voran.

Doch warum wagt das Team rund sieben Jahre nach dem MSCI-Exit eine neue Gründung? Gegenüber unserem Magazin betont Marchand, dass sich der Markt in der Zwischenzeit fundamental gewandelt habe. Bei Carbon Delta habe man noch Pionierarbeit geleistet und Klimarisiken für Finanzmärkte überhaupt erst messbar gemacht. „Heute stehen wir vor dem nächsten Schritt: Wir müssen aus Risikoanalysen konkrete Investitionsentscheidungen machen“, erklärt der Gründer.

Städte und Betreiber kritischer Infrastruktur wüssten heute sehr wohl, dass sie handeln müssen, könnten aber oft nicht systematisch beantworten, welche Maßnahmen den größten Nutzen bringen und wirtschaftlich sinnvoll sind. Klimaanpassung sei kein reines Zukunftsthema mehr, sondern harte operative Realität. „Damals haben wir Risiken messbar gemacht. Jetzt geht es darum, aus diesen Daten echte Entscheidungen abzuleiten“, so Marchand.

Binationale Strategie: Zwischen Finanzplatz und Klimaforschung

Auffällig bei Resilens ist die binationale Aufstellung mit Standorten in Zürich und Potsdam. Für Marchand ist das strategisches Kalkül: Zürich diene mit der Nähe zur ETH, dem Technopark und einem starken Finanzökosystem als Brutstätte. Potsdam wiederum sei durch die Universität und das Institut für Klimafolgenforschung ein bedeutender wissenschaftlicher Hotspot. Zudem sei der deutsche Markt für den öffentlichen Sektor zentral, da Klimaanpassung dort gerade zur operativen Daueraufgabe wird.

Finanziert wird das junge Unternehmen durch Eigenmittel und das Kapital des strategischen Investors Karl Gutbrod. Dieser hat mit meteoblue einen der renommiertesten Anbieter für Klimadaten aufgebaut. Das sei weitaus mehr als reines Risikokapital, unterstreicht Marchand: „Es ist ein klares Signal aus dem Klimadatenmarkt, dass der nächste logische Schritt jetzt die Übersetzung dieser Daten in Entscheidungen ist.“

Die Plattform ist seit Anfang Mai live und durchläuft aktuell die ersten Praxisphasen. Der ehrgeizige Fahrplan für die nächsten Monate steht: Zunächst startet die Software mit dem Thema Hitze, zur Jahresmitte folgen Überschwemmungen, danach Sturm und Trockenheit. Der geografische Fokus liege zunächst auf dem deutschsprachigen Raum, Benelux und den nordischen Ländern, so der CEO, schiebt jedoch mit Nachdruck hinterher: „Langfristig denken wir global. Klimaanpassung ist kein europäisches Spezialthema.“

Der AdaptationReturn als künftiger Branchenstandard?

Das klassische Problem der Klimaanpassung ist finanzieller Natur: Während sich der Return on Investment (ROI) bei der CO₂-Reduktion verhältnismäßig leicht messen lässt, bleibt die wirtschaftliche Rendite von Schutzmaßnahmen schwer fassbar. Anstatt nur Gefahrenzonen farblich zu markieren, will Resilens Kommunen und Unternehmen softwarebasiert helfen, Maßnahmen standortbezogen zu bewerten und belastbare Pläne zu priorisieren. Das Herzstück dieser Kalkulation ist der neue KPI „AdaptationReturn“.

Der Paradigmenwechsel im Überblick:

Kriterium | Bisheriger Marktstandard | Der Resilens-Ansatz |

Fokus | Risikoanalyse (Was passiert wo?) | Handlungsplanung (Was tun wir?) |

Bewertung | Langwierige Consulting-Projekte | Softwarebasierte Priorisierung von Maßnahmen |

Zentrale Metrik | Abstraktes Schadenspotenzial | „AdaptationReturn“ (Belastbare Anpassungspläne) |

Doch wie belastbar kann eine solche Metrik angesichts hochvolatiler Wetterextreme wirklich sein? Auf die kritische Nachfrage, ob das Tool womöglich nur theoretische Best-Case-Szenarien produziere, um Investor*innen zu beruhigen, räumt Marchand unumwunden ein: „Die Volatilität ist real, und genau deshalb bauen wir AdaptationReturn so, wie wir ihn bauen.“ Man verkaufe ganz bewusst keine rosigen Szenarien, sondern eine konservative, prüfbare Entscheidungsgrundlage, die auf etablierten ökonomischen Methoden basiere.

Die Software setze auf maximale Transparenz. „Nehmen Sie ein begrüntes Dach: Es kühlt das Gebäude, speichert Regenwasser, schafft Lebensraum für Insekten und verlängert die Lebensdauer der Dachkonstruktion“, veranschaulicht Marchand das Prinzip. Jeder dieser Vorteile werde einzeln und ohne versteckte Blackbox ausgewiesen, sodass Anwender selbst entscheiden können, welche Faktoren in die Rechnung einfließen.

Das System rechne dabei konsequent konservativ mit wissenschaftlich kaum bestreitbaren Mindestpreisen und warne explizit auch vor Fehlinvestitionen. „Ein belastbarer Business Case zeigt nicht nur, was funktioniert, sondern auch, was nicht funktioniert“, kontert der Gründer.

Bewährungsprobe im B2G-Sektor und die leeren Kassen

Dass die Theorie auch im harten Alltag standhält, zeigt ein Pilotprojekt mit der Stadt Worms, eingebettet in das EU-Programm Pathways2Resilience. Derartige Best-Practice-Beispiele sind überlebenswichtig. Denn Kommunen sind wegen ihrer langwierigen Vergabeverfahren (B2G) berüchtigt und fordern von Start-ups einen extrem langen finanziellen Atem.

Neben dem öffentlichen Sektor bedient Resilens aber auch Industrieunternehmen. Was diese völlig unterschiedlichen Zielgruppen vereint, ist ein neues Berufsbild: das des Klimaanpassungsmanagers. Diese Fachkräfte hätten zwar viele Daten, aber kaum standardisierte Tools. In Worms, wo ein Pilot zum Hitzeschutz für 55 Kitas läuft, zeige sich das Dilemma deutlich. „Die zentrale Frage ist dort nicht, ob Hitze ein Problem ist. Die Frage ist: Welche Einrichtung zuerst, welche Maßnahme, in welcher Reihenfolge“, unterstreicht Marchand. Entscheidend sei, dass Analysen standortbezogen und extrem schnell – in Tagen statt Monaten – vorliegen und sich leicht gegenüber der Politik kommunizieren lassen.

Selbst der perfekt kalkulierte Plan stößt jedoch an Grenzen, wenn am Ende das städtische Budget für die Schutzbauten fehlt. Dem realen Problem knapper Kassen weicht Marchand nicht aus, ordnet es aber anders ein: Geld sei zwar knapp, doch es fließe heute meist einfach nicht systematisch in die effektivsten Projekte.

Zudem verbiete es sich, Klimaanpassung als reine Kostenstelle abzutun. Marchand verweist auf eine Auswertung des Schweizer Bundesamts für Umwelt anhand von 81 Piloten: „Das durchschnittliche Nutzen-Kosten-Verhältnis lag bei 4,7. Kein einziges Projekt lag unter 1,0 und war somit unwirtschaftlich.“ Die Krux liege also nicht in der mangelnden Rentabilität, sondern an deren schwieriger Darstellbarkeit. Gelinge der saubere Business Case, würden sich auch alternative Finanzierungen wie PPP-Modelle oder Versicherungsgelder auftun.

Fazit

Mit Resilens drängt kein naiver Newcomer auf den Markt. Das erfahrene Team adressiert zielgenau einen der größten Schmerzpunkte der ClimateTech-Branche: Die fehlende Übersetzungsleistung zwischen dem nackten Risiko und dessen finanzierbarer Lösung. Zwar ist die Etablierung eines völlig neuen, globalen Standards wie dem AdaptationReturn politisch wie wirtschaftlich ein extrem dickes Brett. Gelingt es dem schweizerisch-deutschen Start-up jedoch, die zähen Vertriebszyklen im öffentlichen Sektor zu überstehen, könnte es im boomenden Markt der Klimaanpassung künftig eine zentrale Schlüsselrolle spielen.

KI-Werkstattmeister: Revolutioniert Kai Karosse die KFZ-Schadensanalyse?

Handyfoto statt Werkstatt-Odyssee: Das Berliner Start-up Kai Karosse verspricht präzise Reparatur-Kostenschätzungen per KI. Ein radikaler Ansatz, der die Branche herausfordert – doch der digitale Blick durch die Smartphone-Kamera hat physikalische Grenzen.

Der Schreckmoment ist fast jedem/jeder Autofahrer*in bekannt: Einmal beim Ausparken unaufmerksam gewesen, und schon prangt eine hässliche Delle im Kotflügel. Was folgt, ist meist eine zeitraubende Odyssee durch Werkstätten, um Kostenvoranschläge zu vergleichen. Das 2025 in Berlin gegründete Start-up Kai Karosse will diesen Prozess nun radikal verkürzen. Die Gründer David Schmeußer und Rico-Thore Kauert verfolgen eine klare Vision: Die Bewertung eines Karosserieschadens soll künftig so einfach funktionieren wie ein Online-Einkauf.

Die 3.000-Euro-Delle und das Versprechen der Transparenz

Die Idee zum Unternehmen entsprang laut David Schmeußer klassischem Alltagsfrust. Vor einer Leasingrückgabe fuhr der Gründer wegen zwei kleiner Dellen in der Tür bei drei verschiedenen Werkstätten vor. „Die Angebote variierten damals zwischen 300 und 3.000 Euro“, erinnert er sich. „Ich fragte mich: Wie kann das sein? Warum ist dieser Markt so intransparent? Warum muss ich als Kunde überall vorstellig werden?“

Den entscheidenden Anstoß gab schließlich seine Frau mit der Frage, warum man nicht einfach eine künstliche Intelligenz nach einem realistischen Preis frage. Eine Marktrecherche ergab zudem, dass jährlich rund eine Million Suchanfragen allein zu Smart Repair und verwandten Themen gestellt werden. Die Lösung der Berliner: Ein virtueller Werkstattmeister, der Kostenschätzungen binnen 30 Sekunden erstellt.

Aus redaktioneller Sicht klingt das nach einer perfekten Lösung für genervte Verbraucher. Allerdings rühren eklatante Preisunterschiede in der Praxis nicht nur von mangelnder Transparenz her, sondern oft von völlig unterschiedlichen Reparaturwegen: Wo die eine Werkstatt spachtelt und beilackiert (Smart Repair), kalkuliert die markengebundene Vertragswerkstatt den strikten Austausch der kompletten Tür nach Herstellervorgaben. Eine KI muss also nicht nur den Schaden erkennen, sondern auch den gewählten Reparaturweg transparent machen.

Domänen-Intelligenz vs. schmutziger Lack

Wie verhindert man, dass der Algorithmus eine teure Erneuerung empfiehlt, wo eine Politur gereicht hätte? Kai Karosse setzt auf eine Analyse-Pipeline, in der das Sprachmodell nur ein Baustein ist. Da Fotos keinen natürlichen Maßstab besitzen, nutzt die KI „Skalenanker“ wie Türgriffe oder Münzen, um die exakte Größe des Schadens zu berechnen.

Doch das Risiko von KI-Halluzinationen – etwa durch Schmutz, Regentropfen oder Spiegelungen im Metalliclack – ist hoch. „Wir nutzen verschiedene Verfahren, um Halluzinationen bestmöglich auszuschließen“, erklärt Schmeußer und nennt sogenannte Confidence-Werte als Instrument. „Wir fragen die KI also: ‚Wie sicher bist du, dass deine Analyse stimmt?‘“ Ist sich der Algorithmus unsicher, wird seine Aussage geringer gewichtet. Zudem muss die KI ihre Entscheidungsfaktoren textlich ausgeben und wird aufgefordert, sich quasi selbst zu überprüfen. „Das ist so, als stelle man die Frage: ‚Bist du ganz sicher? Bitte durchlaufe den Prozess erneut und prüfe, ob dein Ergebnis wirklich valide ist‘“, so der Gründer.

Das Start-up macht hier vieles richtig, indem es dem Algorithmus misstraut. Dennoch: Eine KI, die sich selbst prüft, operiert letztlich nur innerhalb ihrer eigenen Systemgrenzen. Ist das Ausgangsmaterial – das Foto des Kunden bzw. der Kundin – schlecht, nützt auch die beste Selbstprüfung wenig. Das weiß auch Schmeußer und räumt ein, dass der „Faktor Mensch“ oft das größte Hindernis sei. Werden nur verschwommene Nahaufnahmen hochgeladen, fehlen Kontext und Bauteil-Zuordnung.

Der harte Realitätscheck in der Werkstatt

Unter der Haube gleicht das System den Schaden mit einer Eignungsmatrix ab und empfiehlt Smart Repair, konventionelle Reparatur oder Austausch. Die Preise kalibriert das System dabei anhand der Daten einer bundesweit tätigen Werkstattkette mit über 550 Filialen. Hier liegt ein kritischer Flaschenhals des Geschäftsmodells: Die Datenbasis einer einzelnen – wenn auch großen – Kette reicht kaum aus, um das hochkomplexe, regional schwankende Preisgefüge des gesamten deutschen Reparaturmarktes abzubilden.

In der Werkstatt-Zunft regt sich entsprechend Widerstand. „Ja, den gab und gibt es, und er ist sicherlich auch teilweise berechtigt“, gibt sich Schmeußer selbstkritisch. Karosseriebauer warnen vehement davor, dass scheinbare Bagatellschäden oft strukturelle Probleme wie gebrochene Halterungen oder sicherheitsrelevante Airbag-Schäden verbergen. Auch die Preisspannen bei Originalteilen seien für die KI „noch schwer zu berücksichtigen“, gibt der Gründer zu.

Man übermittle bei jeder Schätzung daher transparent die zugrunde liegenden KI-Annahmen. „Ähnlich wie ein erfahrener menschlicher Gutachter wird Kai Karosse solche Risiken mit der Zeit immer besser einschätzen können, je mehr Daten zur Verfügung stehen“, argumentiert Schmeußer. Das System solle künftig lernen, dass etwa bei einer tiefen Delle am Stoßfänger oft auch die Aufhängung beschädigt ist.

Trotz dieser Lernkurve bleibt ein strukturelles Problem bestehen: Wenn die KI vorab 500 Euro prognostiziert, der Meister auf der Hebebühne aber verborgene Schäden für weitere 1.000 Euro entdeckt, droht massiver Kund*innenfrust. Die KI weckt Erwartungen, die die Werkstatt am Ende vielleicht nicht halten kann. Schmeußer sieht das naturgemäß positiver: „Die Hebebühne bleibt natürlich die letzte Instanz, doch der Kunde hat bereits vorab einen Wissensvorsprung. Das ist ein entscheidender Unterschied.“

David gegen die Software-Goliath

Der Markt ist ein Haifischbecken, dominiert von Konzernen wie der Allianz und etablierten Branchenstandards wie Audatex oder DAT, die über jahrzehntelange Datenhistorien verfügen. Wie will ein gebootstrapptes Start-up hier bestehen?

Man wolle Fahrzeugbesitzer*innen einen Weg völlig losgelöst von Versicherungsvorgaben oder Werkstattbindungen bieten, kontert Schmeußer. Gleichzeitig positioniert sich Kai Karosse als B2B-Lösung: „Wir möchten unsere Anwendung Werkstätten zur Verfügung stellen, die ihren Kunden eine einfache und zeitgemäße Lösung anbieten wollen.“

Der Prozess solle radikal vereinfacht werden: „Bild hochladen, Angebot erhalten, Termin buchen, Vorfahren und Schaden beheben lassen. Fertig!“, skizziert Schmeußer seine Idealvorstellung. „Davon ist die Branche derzeit weit entfernt.“

Fazit: Geniales Lead-Tool oder echtes Gutachten?

Das Potenzial für die Software ist unbestritten vorhanden, insbesondere als Lead-Generierung für Werkstätten oder zur groben Vorfilterung im Flottenmanagement. Auf die Frage nach der Entwicklung in den nächsten drei Jahren gibt sich Schmeußer bodenständig: „Wäre Kai Karosse in drei Jahren die erste Anlaufstelle für die Behebung von Karosserieschäden und das Mittel der Wahl für Werkstattwebsites und Flottenanbieter, wäre das ein sehr großer Erfolg.“

Ob dieser Erfolg eintritt, hängt von einer zentralen Frage ab: Kann die Software das Erwartungsmanagement der Nutzer*innen kontrollieren? Kai Karosse liefert aktuell kein belastbares Gutachten, sondern eine smarte Erstindikation. Schafft es das Unternehmen, diese technologische Grenze gegenüber den Autofahrer*innen transparent zu kommunizieren, könnte die Berliner KI tatsächlich viel Frust aus dem Schadensprozess nehmen. Verlässt sich der/die Kund*in aber blind auf die 30-Sekunden-Rechnung des Algorithmus, folgt die Ernüchterung auf dem Fuß – spätestens an der Hebebühne.

Substanz statt Start-up-Glamour

Melanie Kell zeigt, wie man im vermeintlich „unsexy“ Markt der Finanzbuchhaltung ein krisensicheres und hochskalierbares Business aufbaut. In unserem Interview spricht die Unternehmerin über ihren Weg vom Start 2004 bis zum erfolgreichen Mehrheitsverkauf 2024 – und verrät, warum saubere Prozesse am Ende jeden Hype schlagen.

Während viele Gründer*innen-Storys heute von schnellem Wachstum um jeden Preis und kurzlebigen Hypes geprägt sind, zeigt Melanie Kell, dass echter unternehmerischer Erfolg oft leise, beständig und mit viel Substanz entsteht. Bereits im Jahr 2004 gründete sie ihr Unternehmen Kell Outsourcing in einem Feld, das weit weg von jeglichem Start-up-Glamour liegt: dem Outsourcing von Rechnungswesen und Finanzbuchhaltung.

Über zwei Jahrzehnte hinweg hat die Steuerberaterin und Expertin für digitales Rechnungswesen und automatisierte Finanzprozesse im Mittelstand bewiesen, dass Klarheit und Konsequenz in einem vermeintlich „unsexy“ Markt zu einem stabilen und hochgradig skalierbaren Business führen. In einer Zeit, in der wirtschaftliche Unsicherheit und steigende Insolvenzen viele Unternehmen hart treffen, wirkt ihr Fokus auf saubere Finanzprozesse und strategische Weitsicht wie ein Kontrastprogramm zu oberflächlichen Trends. Von der Gründung über die Wachstumsphase ab 2017 bis hin zum erfolgreichen Verkauf der Mehrheitsanteile im Jahr 2024 ist ihr Weg ein echter Zeitstrahl des Unternehmertums. Melanie Kells Geschichte zeigt, dass Sichtbarkeit kein Selbstzweck sein muss, sondern eine bewusste strategische Entscheidung ist.

Im Interview erfährst du, warum gerade die Abkehr vom Hype und die Konzentration auf das Wesentliche die Basis für einen erfolgreichen Exit bildet. Ein Gespräch über den Mut zur Langfristigkeit, die Macht der Zahlen und die Kunst, ein Unternehmen zu bauen, das auch in stürmischen Zeiten funktioniert.

Das Interview

Frau Kell, Sie haben Ihr Unternehmen Kell Outsourcing im Jahr 2004 gegründet. Ihr Fokus liegt auf dem Outsourcing von Rechnungswesen und Finanzbuchhaltung – ein Feld weit weg vom Start-up-Glamour. Warum haben Sie sich damals bewusst für diesen oft als „unsexy“ bezeichneten Markt entschieden?

Melanie Kell: Mein Weg war ehrlich gesagt nicht besonders strategisch. Nach meiner kaufmännischen Ausbildung habe ich BWL studiert. Mit Themen wie Marketing konnte ich mich nie wirklich anfreunden, Steuerwesen dagegen ist mir leichtgefallen. Also habe ich diesen Weg eingeschlagen.

Was mich an diesem Fachbereich bis heute fasziniert: Man bekommt Einblicke in unterschiedlichste Unternehmen. Ich erinnere mich noch gut an meine ersten Wochen in der Wirtschaftsprüfung. Ich war zur Lagerbeobachtung bei einem Marmeladenhersteller kurz nach der Wende in Berlin. Diese Einblicke in echte Wertschöpfung, in Prozesse, in Unternehmen haben mich geprägt. Und genau das motiviert mich bis heute, Unternehmen mit meinem Wissen und meiner Begeisterung für Zahlen am Laufen zu halten.

Es ist doch so: Jedes Unternehmen braucht eine ordentliche Buchhaltung bzw. ein sauberes Rechnungswesen, um gut zu laufen, und tatsächlich merke ich immer wieder, wie selbstverständlich die Arbeit der Buchhaltung bzw. des Rechnungswesens wahrgenommen wird und wie wenig Begeisterung dem Thema zugesprochen wird. Unternehmer*innen sprechen begeistert über Produkte, über ihre Teams und über ihre Vertriebserfolge, ich habe allerdings noch nie einen Unternehmer*in gehört, der bzw. die seine Buchhaltung öffentlich gefeiert hat. Schade eigentlich, denn wir tragen am Ende das Gerüst des Unternehmens.

In der aktuellen Wirtschaftslage steigen die Insolvenzen. Spüren Sie, dass die Bedeutung sauberer Finanzprozesse heute wieder ernster genommen wird, um den gefährlichen „Blindflug“ zu vermeiden?

Melanie Kell: Leider wird die Bedeutung sauberer Finanzprozesse oft erst erkannt, wenn es zu spät ist. Genau da kommt zum Tragen, dass für viele Buchhaltung lästig ist, eine gesetzliche Pflicht, nichts weiter. Ich sehe das komplett anders: In meinen Augen ist sie wichtiger als ein perfekter Social-Media-Auftritt oder Employer Branding. Denn was immer wieder unterschätzt wird: Wenn die Zahlen nicht stimmen, stimmt am Ende gar nichts. Ich würde mir daher viel mehr Fokus, Aufmerksamkeit und Wertschätzung für meinen Fachbereich wünschen.

Ihre Geschichte ist eine Erzählung über Jahre, mit einer starken Wachstumsphase ab 2017. Welche Entscheidungen haben damals den Unterschied gemacht zwischen bloßem „Mitlaufen“ und echtem „Skalieren“?

Melanie Kell: Wir bedienen eine klare Nische. Kleine Unternehmen gehen zum Steuerberater, große machen alles inhouse. Dazwischen entsteht Raum für uns. Der echte Unterschied kam durch Sichtbarkeit. Eine sehr gute Agentur hat es geschafft, uns im Internet sichtbar zu machen. Und das Entscheidende war nicht Technik oder Kreativität – sondern die Fähigkeit der Agentur zuzuhören. Sie können sich vorstellen, dass es ein Problem ist, mit Schlagwörtern wie Buchhaltung im Netz gefunden zu werden. Hier bedarf es eines echten Google-Könners, der das so rausarbeitet, dass man sichtbar wird. Heute arbeite ich intensiv an meiner Sichtbarkeit und dem Brand und an der laufenden Entwicklung meines Vertriebs. Aber es funktioniert, wir dürfen weiterwachsen.

In 20 Jahren Unternehmertum läuft nicht immer alles nach Plan. Gab es eine strategische Fehlentscheidung oder eine besonders kritische Phase, aus der Sie im Nachhinein am meisten gelernt haben?

Melanie Kell: Fehler gehören dazu – jeden Tag. Und auch ich habe Fehler gemacht, keine Frage. Ein Beispiel, das mir bis heute prägend im Kopf geblieben ist: 2009 habe ich eine Steuerberatungskanzlei gekauft, nachdem ich einen großen Kunden verloren hatte. Ich wollte damals Mitarbeitende halten und habe emotional entschieden. Heute würde ich das anders machen. Ich würde das Geld in Marketing investieren, das hätte uns weitergebracht. Aber dieses Learning musste ich machen, um dann Beispielsweise den Wert von gutem Marketing schätzen zu lernen.

Gerade im Rechnungswesen passiert durch Digitalisierung und Automatisierung extrem viel. Welche Rolle spielt künstliche Intelligenz heute in Ihrem Business und wie schätzen Sie die KI-Nutzung in der Finanzbuchhaltung generell ein?

Melanie Kell: Natürlich ist die Anwendung von KI vielseitig und wird vieles ändern. Das Thema ist aber nicht, dass die KI die Prozesse nicht automatisieren kann, das Thema ist mehr wie und wo es ansetzt. Es ist wie in vielen Bereichen; die KI kann einfache Sachverhalte heute schon abbilden. Je komplexer ein Geschäftsmodell ist, desto komplexer müssen auch die KI-Anwendungen sein und so mehr braucht es jemanden, der auch Veränderungen nachhalten kann. Zunächst müssen die Prozesse und Arbeitsschritte, die in die Buchhaltung eingespeist werden, richtig gut sein: richtig und vollständig. Sie würden sich wundern, wenn Sie wüssten, wie viel heute in der Buchhaltung händisch nachgepflegt werden muss. Wichtig ist auch, dass die Organisation möglichst stringent organisiert ist.

Nehmen Sie ein Hotel: Hier gibt es Übernachtungen, Gastronomie, Gutscheine, Events und Vorauszahlungen. Wenn für jeden Bereich das Geld aus einer anderen Quelle kommt, ist es sowohl für die KI als auch für den Buchhalter schwer, das zusammen zu führen. Nur wenn es gut organisiert ist, kann es auch gut automatisiert werden. Ich sage immer, unsere Dienstleistung ist nur so gut wie das, was wir geliefert bekommen. Wir arbeiten am Anfang viel mit unserem neuen Kunden zusammen, um genau das sicherzustellen.

Ein weiterer Punkt ist die Akzeptanz der Kunden und auch meines Teams. Alle müssen das lernen, mit der KI zu arbeiten. Das ist auch ein Prozess, der nicht immer gesehen wird. Unsere Kunden sind komplex und anspruchsvoll, das kann die KI noch nicht an jeder Stelle.

In der Branche herrscht Fachkräftemangel. Wie schaffen Sie es, in einem klassischen Markt Fachkräfte zu gewinnen und langfristig zu binden?

Melanie Kell: Unsere Leute fühlen sich wohl. Wir haben ein gutes Miteinander und arbeiten auf Augenhöhe. Wertschätzung ist kein Schlagwort, sondern Alltag. Und ganz ehrlich: Oft reichen genau diese Dinge. Kultur schlägt viele vermeintlich „moderne“ Benefits. Genau daran arbeite ich, dass wir eine gesunde Unternehmenskultur haben, denn wer Spaß an seiner Arbeit hat und sich wohl fühlt, der kommt gern ins Büro und gibt sein Bestes.

Im Jahr 2024 folgte der Verkauf der Mehrheitsanteile an die Infoniqa Group. Was bedeutet ein solcher Schritt in einem klassischen Business – und wie kommt man strategisch an diesen Punkt?

Melanie Kell: Ich bin wie gesagt keine klassische Strategin, die alles Jahre im Voraus plant. Ich nutze Chancen, wenn sie sich ergeben und Infoniqa hat mir eine Chance geboten, die für mich gepasst hat. Ich bin Ende 50, da spielt das Thema Nachfolge eine Rolle. Gleichzeitig wollte ich weiter wachsen und brauchte technologische Unterstützung.

Sie sagen von sich selbst: „Ich bin keine Rampensau – aber wenn es Sinn ergibt, mache ich es.“ Wie wichtig ist es heute, Sichtbarkeit nicht als Show, sondern als strategisches Werkzeug zu nutzen?

Melanie Kell: Sichtbarkeit wird immer wichtiger. Ich arbeite intensiv an meinem LinkedIn-Profil und daran, das Thema Rechnungswesen verständlicher und greifbarer zu machen. Es geht mir dabei definitiv nicht um Show, sondern um Wirkung. Wenn Sichtbarkeit dazu beiträgt, die richtigen Kunden zu erreichen und Vertrauen aufzubauen, dann ist sie ein strategisches Instrument. Und ich wünsche mir generell mehr Wertschöpfung für Rechnungswesen und da hilft es, konkrete Einblicke in meinen Fachbereich zu geben, um ihn greifbarer zu machen.

Viele Founder-Storys klingen heute nach Wachstum um jeden Preis. Warum hat langfristiges Unternehmertum oft weniger Glamour, aber dafür mehr Substanz?

Melanie Kell: Weil echtes Unternehmertum Ausdauer braucht. Es geht nicht um den schnellen Erfolg, sondern darum, über Jahre hinweg gute Entscheidungen zu treffen und auch mit schwierigen Phasen umzugehen. Das ist weniger glamourös, aber deutlich nachhaltiger.

Zum Abschluss gefragt: Welche drei konkreten Ratschläge geben Sie Gründerinnen und Gründern mit auf den Weg?

Melanie Kell: Gelassenheit. Mut. Und: einfach immer weitermachen.

Danke, Melanie Kell, für die spannenden Insights

Das Interview führte StartingUp-Chefredakteur Hans Luthardt

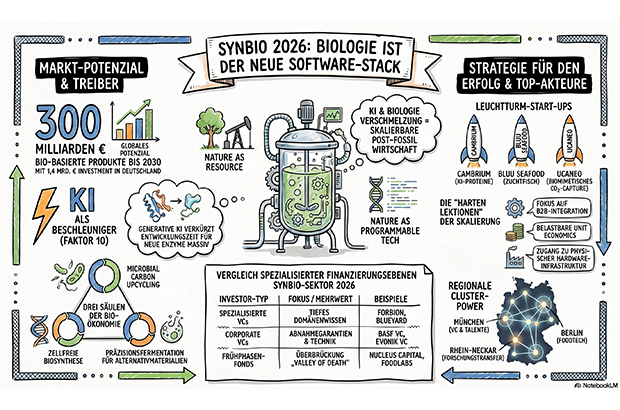

SynBio-Start-up-Report 2026

Biologie ist der neue Code: Wie Synthetische Biologie (SynBio) die Industrie neu programmiert und welche Start-ups dabei hierzulande federführend sind.

Die Vision einer post-fossilen Wirtschaft ist im Jahr 2026 keine bloße Utopie mehr, sondern eine präzise Ingenieursleistung. Wir erleben den Moment, in dem die Natur von einer Ressource, die wir ausbeuten, zu einer Technologie wird, die wir programmieren. In den Laboren der Republik entstehen heute Lösungen für die größten Versorgungskrisen unserer Zeit. Der Aufstieg der Synthetischen Biologie (SynBio) markiert den Übergang vom Zeitalter der Petrochemie in das Zeitalter der Biomanufaktur – eine Transformation, die so tiefgreifend ist wie die industrielle Revolution, jedoch mit der Geschwindigkeit der digitalen Transformation erfolgt.

Wenn Bits auf Atome treffen

Der SynBio-Markt ist 2026 in eine Phase der industriellen Skalierung eingetreten. Aktuelle Analysen der KfW sowie Branchenberichte von BCG beziffern das globale Marktpotenzial für bio-basierte Produkte bis Ende des Jahrzehnts auf über 300 Milliarden Euro. Allein in Deutschland ist das Investitionsvolumen in DeepTech-BioTech-Start-ups im vergangenen Geschäftsjahr laut Bitkom-Daten auf einen Rekordwert von 1,4 Milliarden Euro gestiegen. Der entscheidende technologische Katalysator ist die Verschmelzung von Generativer KI und Biologie. Dank Modellen, die Proteinfaltungen präziser vorhersagen können, als es je ein menschlicher Forscher vermochte, wurde die Entwicklungszeit für neue Enzyme um den Faktor zehn verkürzt. Die Biologie wird damit endgültig zum „Software-Stack“, bei dem Design-Build-Test-Learn-Zyklen in digitalisierten Bio-Gießereien automatisiert ablaufen.

Jenseits der Petrischale: Die Treiber der Bio-Ökonomie

Drei spezifische Sub-Sektoren dominieren in diesem Jahr die Agenda der Investor*innen. An erster Stelle steht die zellfreie Biosynthese, bei der komplexe Moleküle ohne den Einsatz lebender Zellen produziert werden, was die Skalierbarkeit massiv erhöht. Pioniere wie das US-Unternehmen Solugen haben hier den Weg geebnet, doch deutsche Akteure ziehen in der Effizienz der Bioreaktor-Steuerung nach. Ein zweiter massiver Treiber ist das Microbial Carbon Upcycling: Mikroben werden so programmiert, dass sie industrielles CO2 direkt in hochwertige Proteine oder Kunststoffe umwandeln. Hier verschmelzen Klimaschutz und Produktion zu einer Einheit. Drittens sehen wir den Siegeszug der Biomanufaktur bei Alternativmaterialien – sei es durch Biomasse-Fermentation für Lederersatz aus Myzel oder durch echte Präzisionsfermentation, bei der etablierte Akteure wie die bayrische AMSilk zeigen, dass programmierte Spinnenseide-Proteine bereits in Serie gehen können. Die Lieferkette der Mode- und Automobilindustrie wird durch diese Biopolymere radikal dekarbonisiert.

Die harten Lektionen der Skalierung

Der Weg zum Erfolg war jedoch von schmerzhaften Rückschlägen gepflastert. Der prominente Crash des einstigen Branchenlieblings Amyris im Jahr 2023 wirkt bis heute als warnendes Beispiel nach. Das Unternehmen scheiterte trotz Milliardenbewertung an der Komplexität der vertikalen Integration und dem Versuch, gleichzeitig Technologieplattform und B2C-Marke zu sein. Für heutige Gründer*innen haben sich daraus vier fatale Fallstricke herauskristallisiert, die über Sieg oder Niederlage entscheiden. Erstens: Die Ignoranz gegenüber den Unit Economics. Ein Produkt, das im 5-Liter-Maßstab funktioniert, muss im 50.000-Liter-Kessel nicht zwangsläufig profitabel sein. Zweitens: Das „Regulatorik-Vakuum“. Wer die EU-Novel-Food-Verordnungen oder GVO-Richtlinien nicht von Tag eins an in die Produktentwicklung einplant, riskiert Jahre des Stillstands. Drittens: Die Fokussierung auf den Endkonsument*innen statt auf B2B-Integration. Der wahre Hebel liegt in der Lizenzierung von Prozessen an die Industrie. Viertens: Die Unterschätzung der Hardware-Komponente. SynBio ist kein reines Software-Business; ohne Zugang zu physischer Infrastruktur bleibt jede Innovation im Labor gefangen.

Deutschlands Bio-Cluster

Deutschland hat sich im internationalen Vergleich als einer der stärksten Hubs für SynBio etabliert, getrieben durch eine einzigartige Verzahnung von Spitzenforschung und industrieller Basis. In München und dem angeschlossenen IZB Martinsried konzentriert sich die größte Dichte an Venture Capital und Talenten, eng flankiert durch die Exzellenz-Cluster der TU München. Berlin hat sich durch spezialisierte Inkubatoren wie den ProVeg Incubator, Atlantic Food Labs (FoodLabs) und den Science Park Berlin-Buch zum absoluten Zentrum für FoodTech und zelluläre Landwirtschaft entwickelt. Ein weiterer Hotspot ist das Rhein-Neckar-Delta rund um Heidelberg, wo das European Molecular Biology Laboratory (EMBL) und der BioRN-Cluster eine Brücke zwischen Grundlagenforschung und Marktreife schlagen. Aachen punktet mit der RWTH und einer starken Fokussierung auf Bio-Verfahrenstechnik, während der Raum Darmstadt/Frankfurt durch die Nähe zu Giganten wie Merck und die TU Darmstadt als Kraftzentrum für die industrielle Bioproduktion gilt.

Investor*innen-Radar