Aktuelle Events

Neue Berufsbilder durch die Digitalisierung

Schon jetzt hat die Digitalisierung vieles in der Gesellschaft verändert und die Arbeitswelt neu geprägt wie es bspw. dieser digitale Vorreiter zeigt. Auch künftig dürfte es die Digitalisierung sein, die der Berufswelt einen Stempel aufsetzt. Viele Berufe entstanden und entstehen nur aufgrund der digitalen Möglichkeiten – wer hätte vor rund fünfzehn Jahren schon geglaubt, dass es Content Manager für Streamingdienste gebe? Dieser Artikel schaut sich einige Berufsbilder genauer an, die rund um die digitale Welt entstanden sind.

Virtual Assistent

Mittlerweile wissen auch nicht sportaffine Menschen, was ein Personal Trainer ist. Auch Personal Assistents sind bekannt, immerhin sind das die wichtigen Existenzen rund um Stars, die deren Alltag planen. Doch auch im Digitalbereich gibt es diese Hilfen:

- Aufgabengebiete – letztendlich ist der Assistent mit der Sekretärin vergleichbar. Mit Online-Tools, einem Laptop und Smartphone und weiteren Hilfsmitteln helfen die Assistenten ihren Kunden dabei, ein Büro oder Projekt zu managen. Jedoch läuft alles online ab.

- Nutzen – gerade bei Einzelunternehmen oder Betrieben, die über keine festen Büroräume verfügen, sind die virtuellen Assistenten Gold wert. Sie regeln die geschäftlichen Termine, sorgen dafür, dass die wichtigen Unterlagen beim Video Call vorliegen, kommunizieren aber auch mit dem Steuerberater und buchen Flüge und Hotels.

- Voraussetzungen – eine Ausbildung im kaufmännischen Bereich ist eine der wichtigsten Voraussetzungen. Wichtiger ist aber die eigene Erfahrung in dem Bereich. So können auch Quereinsteiger, die vielleicht schon Fangruppen oder auch Sportvereine unterstützt haben, einen Fuß in die Tür bekommen.

SEO-Manager und Co.

Rund um das Thema Suchmaschinenoptimierung sind in den vergangenen Jahren unendlich viele Jobs entstanden. Im Kern dreht sich alles um die bessere Sichtbarkeit, wobei mittlerweile das reine SEO auch plattformbezogen geboten werden kann:

- Optimierung – ob sich die Optimierung von Webseiten, Anzeigen oder anderen Inhalten nun direkt auf Google bezieht, ist heute offen. Spezialisten konzentrieren sich beispielsweise um die Optimierung auf Plattformen wie YouTube, Facebook oder auch Amazon. Im Grunde genommen stellen auch diese Plattformen Suchmaschinen dar, sodass es wichtig ist, die eigenen Inhalte so zu optimieren, dass eine bessere Sichtbarkeit erreicht wird.

- Anforderungen – neben dem grundlegenden Wissen müssen diese Berufsgruppen immer aktuell bleiben. Wer selbst schon einmal seine Homepage optimiert hat, der weiß, dass nach dem letzten Schritt der allererste erneut folgt, da die Suchmaschinen ihre Kriterien geändert haben.

- Voraussetzungen – ein Marketingstudium, aber auch Kenntnisse in der BWL oder Wirtschaftsinformatik sind hilfreich. Das generelle Verständnis über die Mechanismen des Internets, der Umfang mit entsprechenden Tools und eine Grundkenntnis von HTML können das fehlende Studium mitunter aufheben.

Entwickler

Einst war das Feld der digitalen Entwickler stark eingeschränkt. Sie arbeiteten an Programmen, alternativ an Spielen. Und heute? Im Kern sind diese Einsatzgebiete weiterhin vorhanden, doch in einer weitaus größeren Ausprägung. Ein typischer Entwickler kann heute in großen Firmen an ERP-Lösungen arbeiten, Spielesoftwares für große Spieleentwickler entwerfen oder auch für einzelne Firmen gezielte Softwares für die Homepage oder den Appstore schreiben. Gerade auf dem letztgenannten Gebiet ist es möglich, sich rasch zu beweisen und seinen eigenen Betrieb zu gründen: Apps sind mit der neue "Gral" des digitalen Bereichs, und wer eine gute Idee hat und gut programmieren kann, der kann es über den Android oder iOS Store bis hinauf in die Höhen schaffen. Allgemein gilt:

- Voraussetzung – ein Studium im Softwarebereich ist sinnvoll, doch keine direkte Voraussetzung. Wer selbst bereits Programme, Apps und Spiele vorweist, der kann diese durchaus als Sprungbrett nutzen.

- Einsatz – die Einsatzgebiete orientieren sich an den eigenen Stärken. Aber ein Entwickler kann beispielsweise sowohl die Oberfläche für ein Online-Casino erschaffen, als auch einzelne Automatenspiele für den Casinobereich entwickeln. Dasselbe gilt für dementsprechende Apps oder auch Büro- und Softwarelösungen. Vor einer Neuentwicklung kommt die Konkurrenzanalyse. Oft hilft es, in Märkten mit starker Konkurrenz wie bei den Casinos ausführlich die Anbieter zu vergleichen. So lässt sich erfahren, was eine Neuentwicklung an unternehmerischen Chancen bietet.

Online-/Media-Redakteure

Im journalistischen Bereich beginnen gerade Studenten schon während des Studiums damit, ihre Referenzen aufzubauen. Oft geschieht das nicht über die herkömmlichen Wege, sondern über ein eigenes Online-Portal. So mancher Student, der sich später mal in der Sportjournalistik durchsetzen möchte, gestaltete sein eigenes Internetportal. Doch ist dieser Bereich weitaus breiter gefächert:

- Möglichkeiten – neben der Erstellung fester Redaktionspläne und dem eigenen Schreiben, kann sich die Arbeit auch auf einzelne Kanäle und deren Spezifikationen konzentrieren. Gerade der Social Media Bereich ebnet diverse Chancen.

- Voraussetzungen – ein Marketingstudium oder eine journalistische Ausbildung sind oft gefragt, wenn auch keine klare Voraussetzung. Gerade "Hobby-Journalisten", die beispielsweise in ihrer Freizeit ein eigenes Sport- oder Freizeitportal aufbauen und mit fundierten Texten versehen, können dies ab einer gewissen Bekanntheit durchaus anstelle der Ausbildung als Referenz nutzen.

In diesen Bereich fallen zudem die Online Marketing Manager, die praktisch den gewöhnlichen Beruf des Marketing Managers rein auf die digitale Ebene heben. Auch hier greifen unterschiedliche digitale Berufsfelder wieder ineinander. So sollte der Manager natürlich über SEO-Maßnahmen Bescheid wissen und die groben Erfordernisse einzelner Plattformen des Internets kennen und verstehen.

Cover-Designer

Sie gibt es natürlich schon länger, doch seitdem Autoren Bücher und Musiker Alben selbst produzieren und veröffentlichen können, bietet das digitale Design ungeahnte Möglichkeiten. Grundsätzlich hat sich die Kundengruppe enorm vergrößert, da nicht mehr einzelne Kernunternehmen Aufträge vergeben, sondern unzählige Kreative, die für das Design ihres Buches oder Albums einen Experten benötigen. Und es endet nicht beim Cover:

- Webseite – ein Banner auf der Webseite, eventuell ein Avatar für den Webseitbesitzer oder ein Logo für einen kleinen Betrieb – all dies fällt mit in diesen Designbereich.

- Werbematerial – gerade Künstler wünschen sich nicht allein ein Buch- oder MP3-Cover, sondern Werbematerialien. Die Designer erstellen somit auch Postkarten und Lesezeichen – oder können die Nutzungsrechte ihrer Hauptarbeit erweitern und ein Covermotiv so mehrmals an einen Künstler verkaufen.

Fazit – neue Berufe und alte Berufe, die neu erfunden werden

Die Digitalisierung bietet viele neue Berufsbilder und erlaubt es, alte, oft nicht mehr benötigte Berufe, in ein neues Gewand zu kleiden und wiederzubeleben. Gerade für Einzelselbstständige gibt es jetzt schon viele neue Aufgabengebiete, die nicht unbedingt ein offizielles Studium, sondern vorzeigbares Fach- und Praxiswissen erfordern. Auch in der Zukunft werden sich die Berufsbilder des digitalen Bereichs noch weiter ausbilden.

Diese Artikel könnten Sie auch interessieren:

Schluss mit Swipen: Wie vibe deep aus Dating-Frust ein Relationship-Business machen will

Dating-Apps frustrieren, die Einsamkeit wächst. Das Hamburger Start-up vibe deep setzt daher auf „Deep Talk“ statt Swiping. Eine Analyse des neuen Geschäftsmodells, das beweisen will, dass sich mit emotionaler Tiefe ein skalierbares Tech-Unternehmen aufbauen lässt.

Die makroökonomischen und gesellschaftlichen Vorzeichen für eine Neuausrichtung digitaler sozialer Dienste sind eindeutig. Weltweit gilt laut der Weltgesundheitsorganisation (WHO) mittlerweile jede sechste Person als einsam. Allein in Deutschland geben über 42 Prozent der Bevölkerung an, in regelmäßigen Abständen Einsamkeit zu verspüren. Gleichzeitig zeigen klassische, auf raschen Konsum ausgelegte Dating-Apps massive Ermüdungserscheinungen. Die aktiven Nutzer*innenzahlen von Branchengrößen wie Tinder, Bumble und Hinge fielen im vierten Quartal 2024 global um sechs Prozent. Rund 69 Prozent aller heruntergeladenen Dating-Apps werden bereits innerhalb eines Monats wieder gelöscht.

Vor allem die junge Zielgruppe zieht Konsequenzen: Im Jahr 2024 planten 63 Prozent der Generation Z einen bewussten „Social-Media-Detox“ – mehr als jede andere Generation. Der Markt verlangt ganz offensichtlich nach echter Verbindung statt nach oberflächlichem, medialem Dopamin, welches das Fehlen realer Nähe oftmals nur vernebelt.

Genau in diese Lücke der wachsenden Dating-Ermüdung stößt die App vibe deep, mit der das Hamburger Start-up von Lui und Saskia Michalski den Fokus konsequent auf Deep Talk statt Swiping verschiebt.

Vom Content zum Tech-Produkt

Dabei war der Weg zum Tech-Unternehmen für die Gründer*innen, die zunächst als Content-Creator*innen im Bereich nicht-monogamer Lebensweisen erfolgreich wurden, keine klassische Laufbahn. Doch der Schritt in die Tech-Branche war eine logische Konsequenz aus dem wachsenden Frust ihrer Community. „Der Schlüsselmoment war eigentlich ein schleichender“, erinnert sich Saskia. Jahrelang hätten sie fehlende Tiefe und Einsamkeit thematisiert, doch die Probleme der Menschen seien eher gewachsen als geschrumpft. „Content allein bringt Menschen nicht ins Handeln“, konstatiert Saskia. „Er schafft Bewusstsein, aber keine echte Veränderung.“ Daraus sei der Entschluss gereift, ein Werkzeug zu bauen, das konkrete Interaktion ermöglicht.

Lui ergänzt: „Genau daraus ist vibe deep entstanden: als Produkt, nicht als Content-Verlängerung.“ Um das Vorhaben umzusetzen, übernahm er dank seines Hintergrunds in der Tech-Industrie das Product Management. Unterstützt werden die beiden von einem externen CTO, der die Entwicklung mit einem internationalen Team vorantreibt. Doch die Technik sei nur die halbe Miete: „Die eigentliche Innovation liegt nicht nur in der Technologie, sondern im Verständnis von Beziehungen – und genau das bringen wir als Gründer*innen mit“, betont Lui.

Deep Talk statt Dauerkonsum

Im Gegensatz zu bestehenden Plattformen, die auf die Quantität neuer Kontakte ausgelegt sind, setzt vibe deep auf die Intensivierung bereits bestehender Beziehungen. Der Mechanismus ist simpel, aber wirkungsvoll: Die App liefert den Nutzenden individuell angepasste Anregungen und stellt tiefgreifende psychologische Fragen – etwa zum persönlichen Umgang mit Konflikten. Der entscheidende Clou zur Steigerung des Engagements liegt darin, dass die Antworten erst ersichtlich werden, wenn alle beteiligten Parteien sich mit ihren eigenen Erwartungen auseinandergesetzt und diese in der App beantwortet haben.

Flankiert wird dieses Konzept von einer künstlichen Intelligenz, deren Nutzung jedoch streng an die Zustimmung aller Beteiligten geknüpft ist. Gerade beim Umgang mit hochsensiblen Paardaten stellt sich unweigerlich die Frage nach Datensicherheit. Auf Nachfrage versichert Lui strenge Standards: „Wir bauen kein Produkt, das ohne Vertrauen funktionieren kann.“ Er verweist auf Datensparsamkeit, pseudonymisierte Strukturen und die klare Regel, Inhalte nicht für das Training von KI-Modellen zu nutzen.

Saskia präzisiert den ethischen Rahmen der Technologie: Die KI sei darauf ausgelegt, „nicht zu bewerten oder Lösungen vorzugeben, sondern Verbindung zu fördern durch Spiegeln, Nachfragen und Perspektivwechsel“. Dabei bleiben die Algorithmen bewusst in einer unterstützenden, nicht-dominanten Rolle und greifen nur ein, wenn beide Partner*innen dies explizit wünschen. Den Kern ihres Anspruchs fasst Saskia pointiert zusammen: „Die intimsten Gespräche eines Menschen gehören nicht uns – wir dürfen nur den Raum dafür halten.“

Community-Power als Raketenstart im Haifischbecken

Mit über 600.000 Follower*innen über alle sozialen Netzwerke hinweg verfügt das Duo über eine immense organische Reichweite. Diese schlägt sich in den Startmetriken der App wider: In den ersten acht Wochen wurden bereits über 50.000 Fragen von den User*innen beidseitig beantwortet. Zudem verzeichnete die App in den ersten Wochen über 10.000 Installationen und konnte dabei mehr als 300 Premium-Aktivierungen vermerken.

Besonders bemerkenswert sind die emotionalen Erfolgsmetriken: Laut Unternehmensangaben bestätigen 75 Prozent der Nutzenden, dass sich ihr Verhältnis zueinander nach zehn Tagen signifikant verbessert hat. Ehrliche Kommunikation birgt jedoch auch Konsequenzen, denn laut denselben Daten endete jede zehnte Beziehung in diesem Zeitraum mit einer sofortigen Trennung.

Der Markt für „Relationship Care“ wächst und lockt international Wagniskapital an. Zu den Mitbewerbenden zählen das britische Start-up Paired sowie die US-amerikanischen Pendants Agapé und Coral. Im deutschsprachigen Raum konkurriert vibe deep unter anderem mit PAIRfect und recoupling, die durch TV-Show „Die Höhle der Löwen“ nationale Bekanntheit erlangten.

Doch wie grenzt man sich von diesen Millionen-Playern ab? „Viele der bestehenden Player bauen im Kern Therapie-Tools für romantische Zweierbeziehungen. Das bildet aber nur einen sehr kleinen Ausschnitt davon ab, was Beziehung eigentlich ist“, kritisiert Saskia Michalski. Vibe deep begreife Verbundenheit deutlich breiter – ob in Freundschaften, beim Dating oder in offenen Konstellationen. Tatsächlich nutze über die Hälfte der User*innen die App mit mehr als einer Person. „Deshalb bauen wir keine Therapie-App für Paare, sondern eine Infrastruktur für Verbindung“, resümiert Saskia.

Zwischen Viralität und Churn-Gefahr

Die Monetarisierung erfolgt derzeit über ein monatliches Abo-Modell, das dem Start-up verlässliche wiederkehrende Umsätze (MRR) sichern soll und tiefere Einblicke sowie mehr KI-Funktionen freischaltet. Für Lui war dieser erste Schritt ein erfolgreicher Test: „Die Frage war, ob Menschen grundsätzlich bereit sind, für tiefere Verbindung zu zahlen. Und die Antwort ist klar: Ja.“ Gleichzeitig räumt er ein, dass die App weniger als Daily-Produkt, sondern eher in intensiven emotionalen Peak-Phasen genutzt wird, weshalb man nun auch mit Wochen- und Jahres-Abos experimentiere. Finanziell agiert das Duo bislang völlig eigenständig („100% bootstrapped“), schließt aber externe Investor*innen für die nächste Wachstumsphase nicht aus. „In sechs Monaten können wir diese Frage also sicherlich schon deutlich präziser beantworten“, so Lui.

Das Geschäftsmodell ist ein klassisches Beispiel für die Monetarisierung innerhalb der Creator Economy. Durch die riesige Community bleiben die Akquisekosten extrem niedrig. Zudem erzeugt die Mechanik der zunächst verborgenen Antworten einen eingebauten Viral-Loop, der enorme Neugier weckt. Dennoch zeigen sich Skalierungsrisiken: Mit einer Conversion-Rate von rund drei Prozent muss vibe deep beweisen, dass es den Sprung aus der Influencer*innen-Blase in den Massenmarkt schafft.

Die größte Herausforderung bleibt das branchenbekannte „Churn-Paradoxon“: Löst die App ihr Versprechen ein und heilt die Beziehung – oder führt sie zur Trennung –, entfällt auf Dauer der primäre Use Case für die Endkonsument*innen.

Saskia widerspricht dieser Lesart jedoch energisch. Das Paradoxon basiere auf einem überholten Verständnis von Beziehungen, bei dem man ein Problem löst und dann „fertig“ sei. „Verbindung ist kein Zustand, den man einmal erreicht, sondern etwas, das sich ständig verändert“, analysiert Saskia. Weil die Nutzenden die App über mehrere Verbindungen und Lebensphasen hinweg nutzen, steige der Customer Lifetime Value ganz natürlich.

Perspektivisch plant das Start-up zudem Erweiterungen im B2B2C-Bereich, etwa als Begleit-Tool für Coaches und Paartherapeut*innen oder für das Team-Building in Unternehmen. Der Fokus bleibe vorerst jedoch auf den Endkonsument*innen. Saskia Michalski bringt die Vision selbstbewusst auf den Punkt: „Wir bauen kein Tool für ein Problem, das verschwindet, sondern für etwas, das immer wieder entsteht.“

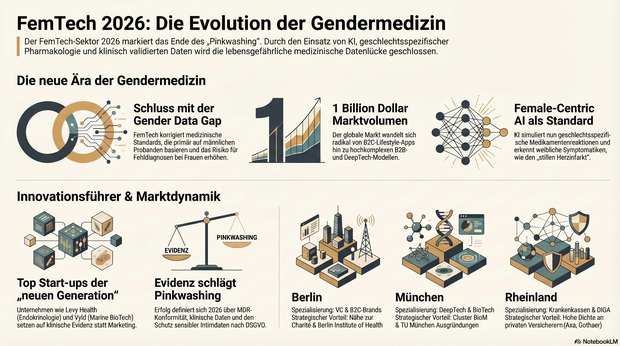

FemTech-Start-up-Report 2026

Schluss mit Pinkwashing! Wie deutsche FemTech-Start-ups 2026 die Gender Data Gap schließen und unser Gesundheitssystem neu codieren.

Lange Zeit belächelt, in eine rosarote Lifestyle-Ecke gedrängt und von männlich dominierten Investment-Komitees als Nischenthema abgetan: FemTech hat einen beispiellosen Reifeprozess hinter sich. Doch der eigentliche Paradigmenwechsel des Jahres 2026 findet tief in der Pharmakologie und der klinischen Forschung statt. Jahrzehntelang galt in der Medizin der 70 Kilogramm schwere Durchschnittsmann als universeller Standard. Die fatale Folge dieser sogenannten Gender Data Gap ist, dass Medikamente primär an männlichen Probanden getestet wurden, weshalb Frauen bis heute ein dramatisch höheres Risiko für Fehldiagnosen und schwere Nebenwirkungen tragen. Der weibliche Körper verstoffwechselt Wirkstoffe aufgrund hormoneller Zyklen und abweichender Enzymaktivitäten völlig anders. Vom einstigen Tabuthema zum DeepTech-Sektor beweist die Branche heute, dass geschlechtsspezifische Medizin kein Nischendasein mehr fristet, sondern ein systemkritisches Versäumnis korrigiert. FemTech schließt endlich diese lebensgefährliche Datenlücke und wird so zum unverzichtbaren Rückgrat einer gerechten, digitalen Medizin.

Datenpower gegen die medizinische Unsichtbarkeit

Der globale Markt für Frauengesundheit steuert laut aktuellen Analysen von McKinsey weltweit auf die Eine-Billion-Dollar-Marke zu. In Deutschland zeigt sich 2026 eine deutliche Konsolidierung. Während die Dealroom-Daten nach dem Hype der frühen 2020er Jahre zunächst eine Delle verzeichneten, hat sich das Investitionsvolumen in der DACH-Region mittlerweile auf einem konstant hohen Niveau stabilisiert. Laut einer Einschätzung der KfW fließen die Gelder heute jedoch smarter: Weg vom überfüllten B2C-Consumer-Markt, hin zu B2B-Modellen und DeepTech.

Der unangefochtene Haupttreiber in diesem Jahr ist die künstliche Intelligenz, die in der Diagnostik, bei der Mustererkennung von Biomarkern und vor allem in der Simulation geschlechtsspezifischer Medikamentenreaktionen neue Standards setzt. Series-A-Runden im zweistelligen Millionenbereich sind für wissenschaftlich validierte Geschäftsmodelle in Deutschland keine Seltenheit mehr, da die Erkenntnis gereift ist, dass eine Medizin, die die Hälfte der Menschheit ignoriert, schlichtweg ökonomisch ineffizient ist.

Gender-Pharmakologie und Female-Centric AI

Die FemTech-Welle der ersten Stunde wurde von Menstruations-Apps dominiert. Pioniere wie das Berliner Start-up Clue haben dafür den Weg bereitet. Doch 2026 dominieren völlig neue, hochkomplexe Sub-Sektoren das Feld. Erstens sehen wir einen massiven Push im Bereich der geschlechtsspezifischen Pharmakologie. Da der weibliche Metabolismus stark von Hormonzyklen beeinflusst wird, nutzen Start-ups heute synthetische Daten und KI, um virtuelle klinische Studien an weiblichen Profilen durchzuführen. Zweitens rückt die geschlechtsspezifische Kardiologie und Onkologie in den Fokus, bei der Algorithmen explizit auf weibliche Symptomatiken – wie den oft unerkannten „stillen Herzinfarkt“ bei Frauen – trainiert werden. Drittens boomt das Metabolische Biomonitoring, das präventiv Autoimmunerkrankungen trackt, die Frauen überproportional oft betreffen. Diese Entwicklung wird massiv durch Einrichtungen wie das Institut für Geschlechterforschung in der Medizin (GiM) an der Berliner Charité flankiert, das die klinische Gendermedizin maßgeblich vorantreibt.

Die Lektionen aus dem Crash der Lifestyle-Apps

Dass der Weg zur Profitabilität steinig ist, zeigte in der jüngeren Vergangenheit das spektakuläre Scheitern des US-Konzerns FemTec Health, der nach einer aggressiven Übernahmewelle – unter anderem des einstigen Schweizer Vorzeige-Start-ups Ava – grandios implodierte. Aus diesem Crash lassen sich für heutige Gründer*innen vier fatale Fallstricke ableiten. Der erste und wichtigste Fehler war die gnadenlose Unterschätzung der europäischen Medizinprodukteverordnung (MDR), die vielen Hardware-Produkten im Nachhinein das Genick brach. Zweitens offenbarten sich völlig zerstörte Unit Economics, da reine Direct-to-Consumer-Modelle durch exorbitante Marketingkosten unprofitabel wurden. Ein dritter Irrtum war das „Pinkwashing“: Es wurde mehr Budget in Lifestyle-Marketing gepumpt als in echte klinische Evidenz, was den Zugang zu essenziellen Krankenkassen-Erstattungen blockierte. Der vierte Fallstrick war die fehlende Spezialisierung auf Gender-Daten; Unternehmen, die lediglich eine weibliche Benutzeroberfläche für männliche Medizinstandards bauten, scheiterten am mangelnden medizinischen Mehrwert.

Wo die geschlechtsspezifische Innovation hierzulande pulsiert

Deutschlands FemTech-Landschaft konzentriert sich 2026 auf hochspezialisierte Hubs. Berlin bleibt der absolute Magnet für Venture Capital und B2C-Brands, stark befeuert durch die Nähe zur Charité und dem Berlin Institute of Health (BIH), das intensiv an der Schließung der Gender Data Gap arbeitet. München hat sich hingegen als das Epizentrum für DeepTech und BioTech etabliert, getragen von den exzellenten Ausgründungen der TU München und dem Cluster BioM. Ein oft unterschätzter, aber extrem relevanter Hotspot ist das Rheinland, insbesondere die Achse Köln/Bonn. Durch die hohe Dichte an privaten Krankenversicherern und Kooperationspartnern wie der Axa oder Gothaer ist dies der ideale Boden für Start-ups, die auf DiGA-Zulassungen schielen. Die Rhein-Neckar-Region um Heidelberg fungiert dank des Deutschen Krebsforschungszentrums (DKFZ) und dem Medizintechnologie-Cluster CUBEX in Mannheim als entscheidende Brücke zwischen harter Onkologie und frauenspezifischer Gesundheitsforschung.

Investor*innen-Radar

Die Investor*innenlandschaft hat sich massiv ausdifferenziert und gleicht 2026 einem hochprofessionellen Ökosystem. Auf der ersten Ebene agieren spezialisierte VCs wie der Auxxo Female Catalyst Fund oder Calm/Storm Ventures, die den Markt mit tiefer Expertise treiben. Die zweite Ebene bilden die Top-Tier Generalisten: Adressen wie Cherry Ventures, HV Capital und der spezialisierte Ableger Earlybird Health haben den ROI von FemTech längst erkannt. Drittens greifen Corporate VCs der Industrie massiv ein; hier positionieren sich Einheiten wie Bayer G4A oder der Roche Venture Fund frühzeitig, um sich strategische Innovationen im Diagnostikbereich zu sichern. Das Fundament bilden hochaktive Business Angels wie Gloria Bäuerlein, Gesa Miczaika und Startup-Verbands-Präsidentin Verena Pausder, die mit ihren Investments echte Signalwirkung erzeugen, während Syndikate wie encourageventures entscheidende Brücken in den Pre-Seed-Phasen bauen.

Die Top Start-ups (Must-Watch)

Für die folgende Auswahl der Top Start-ups des Jahres 2026 haben wir strenge Kriterien angelegt. Im Fokus stehen ausschließlich in Deutschland ansässige Unternehmen der „neuen Generation“ mit einem Gründungsjahr ab 2020. Wir bewerten die Marktrelevanz im Kontext der Gender-Medizin, den technologischen Reifegrad, das Vertrauen namhafter Lead-Investor*innen sowie die Fähigkeit, echte medizinische Datenlücken zu schließen. Die Redaktion hat diese Auswahl unabhängig und ohne finanzielle Gegenleistungen getroffen.

Levy Health (Gründung: 2021)

Das in Berlin gegründete Trio Caroline Mitterdorfer, Priv.-Doz. Dr. med. Theresa Vilsmaier und Silvia Hecher adressiert die komplexe Welt der Endokrinologie. Ihr B2B-SaaS-Produkt ist eine CE-zertifizierte Software zur klinischen Entscheidungsunterstützung, die Mediziner*innen hilft, die wahren Ursachen für weibliche Unfruchtbarkeit schneller zu entschlüsseln. Statt nur hormonelle Daten aufzubereiten, analysiert der Algorithmus umfassende klinische Parameter und Laborwerte, um eine massive diagnostische Lücke in der Reproduktionsmedizin zu schließen. Wie enorm das Skalierungspotenzial dieser Technologie ist, zeigte sich bei einer Seed-Runde über 4,5 Millionen US-Dollar: Angeführt vom US-Fonds XYZ Venture Capital und begleitet von Atlantic Labs, nutzte Levy Health das Kapital, um seinen Hauptsitz strategisch nach San Francisco zu verlegen – während Berlin die entscheidende europäische Entwicklungsbasis bleibt

Ovom Care (Gründung: 2023)

Felicia von Reden, die Gynäkologin Dr. Lynae Brayboy und die renommierte Embryologin Dr. Cristina Hickman heben die Reproduktionsmedizin mit Ovom Care auf ein neues Level. Das als Spin-off des Berliner KI-Studios Merantix gestartete Unternehmen verbindet reale physische Kinderwunschzentren – mit ersten Klinik-Standorten in Lissabon und Großbritannien – mit einer hochkomplexen Software zur Therapieplanung. Der USP: Der Algorithmus nutzt globale Patientinnendaten, um IVF-Behandlungen präzise auf den individuellen weiblichen Körper zuzuschneiden. Für diese technologische Schließung der Datenlücke sammelte das Start-up in einer Seed-Runde 4,8 Millionen Euro ein, angeführt vom Deep-Tech-VC Alpha Intelligence Capital (AIC) unter strategischer Beteiligung von Merantix und Ananda Impact Ventures.

Endo Health (Gründung: 2020)

Die Gynäkologin Dr. med. Nadine Rohloff und der Wirtschaftsinformatiker Markus Rothenhöfer (CIO) haben mit der in Chemnitz ansässigen Endo Health GmbH ein Unternehmen geschaffen, das sich lange Zeit exklusiv der Krankheit Endometriose widmete. Das Ursprungsmodell basiert auf der Endo-App, einer digitalen Gesundheitsanwendung (DiGA), die offiziell vom BfArM gelistet ist und auf Kassenkosten verschrieben werden kann. Im Jahr 2025 vollzog das Start-up jedoch den strategischen Sprung zur Multi-Disease-Plattform und launchte mit „Paula“ eine innovative App-Lösung für Betroffene des Polyzystischen Ovarialsyndroms (PCOS). Dieses enorme technologische Skalierungspotenzial für chronische Frauenkrankheiten überzeugte Geldgeber: Zu den Investoren der jüngsten Expansionsrunden zählen unter anderem Atreyu Investments, Cimexia GmbH, der Berlin Angel Fund und IBB Ventures.

Femfeel (Gründung: 2020)

Das Gründungstrio Janna Kraft, Marie Reger und Michaela Lehr widmet sich mit Femfeel der weiblichen Lebensmitte und überführt die Menopause in die digitale Versorgung. Ihr smartes B2B2C-Modell umgeht langwierige Rezept-Prozesse: Femfeel kombiniert App-basierte Begleitung mit evidenzbasierten Lebensstil-Interventionen, die offiziell als Präventionskurse (nach § 20 SGB V) zertifiziert sind und somit direkt von den Krankenkassen erstattet werden. Wie enorm wertvoll dieser präventive Markt geworden ist, bewies Femfeel durch einen hochbeachteten Exit: Das Start-up wurde von der Medice Health Family – einem Schwergewicht des deutschen Pharma-Mittelstands – übernommen und in dessen Digital-Health-Sparte integriert. Ein historisches Paradebeispiel dafür, wie stark die etablierte Industrie aktuell im FemTech-Sektor konsolidiert.

Frieda (Gründung: 2020)

Valentina Ullrich, Dr. med. Kai Schulze-Wundling und Thanh Schrader-Nguyen adressieren mit Frieda die Gendermedizin in der Menopause und gehen dabei tief in die klinische Diagnostik. Ursprünglich unter dem Namen Loba Health gestartet, agiert das Unternehmen heute als hybride digitale Klinik. Der USP: Statt den Östrogenabfall als Lifestyle-Thema abzutun, kombiniert Frieda datengestützte Telemedizin mit digitaler kognitiver Verhaltenstherapie (CBT) für eine evidenzbasierte Behandlung. Die Menopause wird hier als diagnostisches Fenster begriffen, um Gesundheitsdaten zur aktiven Prävention von altersbedingten Folgekrankheiten (wie Osteoporose) zu nutzen. Dieser konsequente Ansatz überzeugte auch den Schweizer Company Builder Maximon, der diese Brücke zur Langlebigkeit (Longevity) mit einem Seed-Investment von 2,5 Millionen Euro untermauerte.

Vyld (Gründung: 2021)

Ines Schiller und Melanie Schichan transformieren mit Vyld die Monatshygiene durch marine Biotechnologie. Das Start-up bietet sogenannte Kelpons aus Meeresalgen an. Dieser Rohstoff ist nicht nur radikal nachhaltig, sondern liefert einen massiven medizinischen USP: Algen sind von Natur aus hypoallergen, extrem saugfähig und kommen ohne schädliche Bleichmittel oder PFAS (Ewigkeitschemikalien) aus, was das empfindliche vaginale Mikrobiom aktiv schützt. Radikal ist bei Vyld auch die Struktur: Das Start-up agiert im Verantwortungseigentum (Steward-Ownership), wodurch Unternehmenszweck und Sicherheit stets vor kurzfristiger Gewinnmaximierung der Gesellschafter stehen. Dass dieser ethische DeepTech-Ansatz massiv skalieren kann, beweist die Finanzierung: Neben Impact-Investoren wie The Case for Her und millionenschweren Crowdinvesting-Instrumenten wird die Materialforschung von Vyld durch signifikante Fördermittel des Bundesministeriums für Bildung und Forschung (BMBF) validiert.

theblood (Gründung: 2022)

Das Gründerinnen-Duo Isabelle Guenou und Miriam Santer nutzt Menstruationsblut als diagnostische Goldmine. Ihr Geschäftsmodell basiert auf einer innovativen, nicht-invasiven Analyseplattform, die das lange tabuisierte Menstruationsblut nutzt, um ein breites Spektrum an Biomarkern – von Sexualhormonen bis hin zu essenziellen Nährstoffen wie Ferritin (Eisen) – zu tracken. Ein natürliches, zyklisches Abfallprodukt wird so zum hochwertigen Datensatz für die präventive Gesundheitsvorsorge, ganz ohne Nadelstich beim Arzt. Wie resilient und marktreif das Duo agiert, bewies es nach einem medienwirksam geplatzten TV-Investment („Die Höhle der Löwen“): theblood ließ sich nicht beirren und holte stattdessen hochkarätige strategische Partner an Bord. Dass dieser Ansatz massives Vertrauen genießt, zeigt die heutige Riege der Geldgeber: Neben Roosh Ventures und RoX Health investierte unter anderem Klosterfrau Ventures strategisch in die Berliner Pionierarbeit.

Internationaler Ausblick & Fazit

Der Blick über die deutschen Grenzen zeigt 2026 klar, in welche Richtung der Kompass navigiert. Aus den USA schwappt eine massive Welle der KI-basierten Wirkstoffentdeckung speziell für gynäkologische Erkrankungen nach Europa, während Asien die Hardware-Miniaturisierung für kontinuierliches Hormon-Tracking vorantreibt. Ein entscheidender globaler Makro-Trend ist jedoch die Souveränität der Intimdaten. In einer volatilen regulatorischen Ära in den USA (Post-Roe-v.-Wade) hat sich die europäische DSGVO vom Standortnachteil zum ultimativen Wettbewerbsvorteil entwickelt. Internationale Nutzerinnen suchen zunehmend Schutz bei europäischen Plattformen, die strikte Datensicherheit garantieren. Dies eröffnet deutschen Start-ups ungeahnte Exportchancen als absolute Vertrauensführer.

Für Gründer*innen und Investor*innen bedeutet dies: Die Zeit der reinen Wellness-Gadgets ist endgültig vorbei. Wer 2026 erfolgreich sein will, muss die Gender Data Gap schließen, klinische Evidenz liefern und den Datenschutz als ethisches Fundament begreifen. FemTech ist kein Nischen-Portfolio-Baustein mehr für die Diversity-Quote, sondern der am stärksten unterbewertete Treiber für die Zukunft der gesamten Gesundheitsökonomie. Wer heute in Gender-Medizin investiert, investiert in die Qualität der Medizin von morgen.

Blockchain-Start-up-Report 2026

Vorbei die Zeit der Krypto-Casinos: 2026 ist Blockchain das unsichtbare Betriebssystem der Wirtschaft. Die Top Start-ups, VCs und Trends im großen StartingUp-Report.

Es fühlt sich an wie ein anderes Zeitalter, wenn man auf die wilden frühen 2020er Jahre zurückblickt. Damals dominierten fliegende Hunde-Münzen wie Dogecoin, überteuerte Affen-Bilder des Bored Ape Yacht Club und toxische Goldgräberstimmung die Schlagzeilen. Heute, im Jahr 2026, hat die Blockchain-Technologie ihre Pubertät endgültig hinter sich gelassen. Der Wandel vom spekulativen Nischenthema zur unverzichtbaren Infrastruktur ist vollzogen. Wir sprechen nicht mehr über Krypto als Anlageklasse für Zocke*innen, sondern über distributed Ledger als das unsichtbare Betriebssystem der globalen Wirtschaft. Die Technologie ist leise geworden – und genau darin liegt ihr heutiger Wert für die Start-up-Welt.

Wenn Systemrelevanz auf MiCA trifft

Der europäische Markt für Web3- und Blockchain-Technologien hat einen nie dagewesenen Reifegrad erreicht. Der entscheidende Befreiungsschlag war die vollständige Implementierung der europäischen MiCA-Verordnung (Markets in Crypto-Assets), die den Kontinent vom regulatorischen Flickenteppich zum sichersten Hafen für institutionelles Kapital gemacht hat. Aktuelle Erhebungen des Bitkom und des KfW-Research zeigen, dass im Jahr 2026 bereits über 35 Prozent des deutschen Mittelstands die Technologie aktiv evaluieren oder Pilotprojekte mit Blockchain-Infrastruktur betreiben – primär im Supply-Chain-Management und der automatisierten Abrechnung.

Auf Investor*innenseite hat sich das Bild gewandelt: Statt Milliarden in unregulierte Token-Sales zu pumpen, fließen aktuell jährlich rund 1,8 Milliarden Euro klassisches Venture Capital in echte Equity-Runden der DACH-Region. Der absolute technologische Haupttreiber ist dabei die Konvergenz von künstlicher Intelligenz und Blockchain. Da KI-Agenten zunehmend autonom wirtschaftlich handeln, benötigen sie ein dezentrales, programmierbares und vor allem grenzenloses Zahlungssystem. Die Blockchain liefert exakt diese finanzielle Abwicklungsschicht für die Maschinenökonomie.

Die neuen Treiber jenseits der Krypto-Börsen

Wer heute noch Krypto-Exchanges oder reine NFT-Marktplätze baut, baut für die Vergangenheit. Der Markt des Jahres 2026 wird von drei hochspezifischen Sub-Sektoren dominiert, die das Internet grundlegend neu vernetzen.

- An vorderster Front steht DePIN (Decentralized Physical Infrastructure Networks). Hierbei wird reale Hardware – von Solarpanels bis hin zu 5G-Antennen – über Token-Incentives dezentral gesteuert und finanziert.

- Ebenso mächtig ist die Tokenisierung von Real World Assets (RWA), die den traditionellen Finanzmarkt revolutioniert, indem sie Anleihen, Immobilien und Kredite liquide auf die Chain bringt.

- Der dritte große Treiber sind Zero-Knowledge Proofs (ZKPs) – kryptografische Protokolle, die es Unternehmen erlauben, die Authentizität von Daten auf öffentlichen Blockchains zu beweisen, ohne sensible Geschäftsgeheimnisse offenzulegen. Globale Pioniere wie das auf RWA spezialisierte Netzwerk Centrifuge oder das US-Projekt Helium im Bereich DePIN haben den Weg geebnet, auf dem europäische Gründer*innen nun hochskalierbare B2B-Lösungen errichten.

Die Lektionen aus dem Billionen-Kollaps

Doch diese Reife hat einen extrem hohen Preis gekostet. Der spektakuläre Zusammenbruch der Krypto-Börse FTX und das Implodieren des algorithmischen Stablecoins Terra/Luna vor wenigen Jahren dienen heute als mahnendes Pflichtprogramm in jedem BWL-Seminar. Damals verdampften hunderte Milliarden Dollar, weil Gier über Substanz siegte.

Aus diesem Epochen-Crash lassen sich für heutige Gründer*innen vier fatale Fallstricke ableiten, die absolut tödlich enden:

- Der erste Irrtum liegt in der regulatorischen Arbitrage: Wer glaubt, Gesetze durch Offshore-Konstrukte und das Mantra "Code is Law" umgehen zu können, scheitert heute an gnadenlosen Aufsichtsbehörden.

- Zweitens zerstören künstlich aufgeblähte Token-Mechaniken jedes Projekt. Wenn die Unit Economics nur durch das permanente Drucken neuer Token künstlich positiv gehalten werden (Ponzinomics), bricht das Kartenhaus bei der geringsten Marktkorrektur zusammen.

- Die dritte Lektion betrifft den ewigen B2C-Fokus. Der verzweifelte Versuch, Endkund*innen komplexe Wallets und Seed-Phrases aufzuzwingen, ist gescheitert; der wahre Wert der Blockchain liegt derzeit fast ausschließlich in B2B-Lösungen, die im Hintergrund agieren.

- Zuletzt war das fehlende Treasury-Management ein Genickbruch für hunderte Teams. Wer die Reserven seines Unternehmens im eigenen, hochvolatilen Token hielt anstatt in Fiat oder echten Stablecoins, war bei Markteinbrüchen über Nacht insolvent.

Das deutsche Netzwerk: Wo die Knotenpunkte entstehen

Deutschland hat sich in dieser neuen Ära extrem smart positioniert und eine dezentrale Hub-Struktur aufgebaut, die weltweit ihresgleichen sucht. Berlin bleibt die unangefochtene Web3-Hauptstadt Europas. Die tiefe Verwurzelung der Ethereum Foundation und eine massive Dichte an internationalen Tech-Talenten machen die Spree-Metropole zum Epizentrum für Protokoll-Entwickler und Layer-1-Infrastruktur. Frankfurt am Main hat sich im Gegensatz dazu als der Hub für institutionelles DeFi (Decentralized Finance) und RWA-Tokenisierung etabliert. Hier verschmilzt die klassische Bankenwelt durch treibende Kräfte wie das Frankfurt School Blockchain Center mit der neuen Technologie. München spielt seine Trümpfe an der Schnittstelle von DeepTech, KI und Enterprise-Blockchain aus, stark befeuert durch Ausgründungen der TU München und die Nähe zu den Corporate Venture Labs von BMW und Siemens. Die heimliche Hauptstadt für den Milliardenmarkt DePIN ist jedoch die Achse Stuttgart/Karlsruhe. Durch das geballte Ingenieurswissen der Automobilzulieferer, gepaart mit Initiativen rund um Bosch, entsteht hier die direkte Verbindung zwischen dezentralen Netzwerken und der physischen Maschinen- und Mobilitätswelt.

Investor*innen-Radar: Smart Money für das Web3

Wer im Jahr 2026 eine Krypto-Infrastruktur finanzieren will, trifft auf eine hochgradig professionalisierte Investor*innenlandschaft. Auf der einen Seite agieren die spezialisierten VCs wie Greenfield Capital, Cherry Crypto oder 1kx. Sie bringen die notwendige technische Tiefe mit, um komplexe Zero-Knowledge-Architekturen oder Token-Design auf Herz und Nieren zu prüfen. Auf der anderen Seite stehen die Top-Tier Generalisten. Häuser wie Earlybird, Point Nine oder HV Capital haben intern längst dedizierte Web3-Partner aufgebaut und führen heute massive Series-A- und B-Runden an, sobald Start-ups bewiesen haben, dass ihre Technologie echte Kundenprobleme löst.

Ein massiver Wachstumsfaktor sind zudem die Corporate VCs der Industrie, allen voran CommerzVentures im FinTech-Sektor oder Porsche Ventures, die Brücken in die klassische Wirtschaft bauen. Der eigentliche Frühphasen-Motor wird jedoch von einer extrem agilen Angel-Szene angetrieben. Erfahrene Ex-Gründer wie Peter Großkopf oder gut vernetzte Angel-Syndikate recyceln ihr Kapital aus vergangenen Zyklen und finanzieren Pre-Seed-Runden oft innerhalb weniger Wochen.

Die Top Blockchain-Start-ups: Unsere Must-Watch Liste 2026

Für unsere Watchlist haben wir klare Kriterien angelegt. Die Auswahl umfasst ausschließlich deutsche Start-ups (mit Hauptsitz oder massiver Präsenz und Wurzeln hierzulande), die ab dem Jahr 2020 gegründet wurden. Wir haben Projekte aussortiert, die rein auf spekulativen Token-Sales basieren. Stattdessen lag unser Fokus auf Marktrelevanz nach dem Krypto-Winter, institutionellem Investor*innen-Vertrauen, technologischer Substanz und einem klaren Product-Market-Fit im B2B- oder tiefen Infrastrukturbereich.

Safe (Gründung 2022)

Das von Lukas Schor, Richard Meissner und Tobias Schubotz als Gnosis-Spin-off gegründete Safe betreibt eine B2B/B2C Smart Contract Account Infrastruktur. Der absolute USP ist die Account-Abstraktion und ihr Multi-Sig-Sicherheitsstandard, der mittlerweile das globale Rückgrat für die Verwahrung digitaler Assets durch Institutionen und DAOs bildet. In den letzten Runden sammelte das Team über 100 Millionen US-Dollar ein, angeführt von Schwergewichten wie 1kx und Tiger Global.

Peaq (Gründung 2020)

Till Wendler, Leonard Dorlöchter und Max Thake bauen mit Peaq eine hochspezialisierte B2B Layer-1 Blockchain. Ihre Technologie ist exakt auf den rasant wachsenden DePIN-Sektor und die "Economy of Things" zugeschnitten, wodurch Maschinen, Fahrzeuge und Roboter souveräne digitale Identitäten und Wallets erhalten. Die jüngsten Wachstumsrunden wurden unter anderem von Generative Ventures und Borderless Capital mit gut 15 Millionen Dollar als Lead-Investoren getragen.

Chainflip (Gründung 2020)

Simon Harman hat mit Chainflip eine B2B2C Cross-Chain Decentralized Exchange (DEX) in Berlin etabliert. Der technologische Vorsprung liegt im nativen Tausch von Krypto-Assets über verschiedene Blockchains hinweg (wie Bitcoin zu Ethereum), ohne dass Nutzer*innen anfällige "Wrapped Tokens" oder unsichere Bridges nutzen müssen. Pantera Capital und Framework Ventures glaubten früh an die Vision und führten Investments in Höhe von über 24 Millionen Dollar an.

Arcium (ehemals Elusiv, Gründung 2022)

Yannik Schrade, Julian Deschler und ihre Co-Founder adressieren mit Arcium eines der größten Probleme der Enterprise-Adoption: Privatsphäre auf öffentlichen Blockchains. Ihr Geschäftsmodell ist ein B2B Confidential Computing Network, dessen USP in der Nutzung von Zero-Knowledge Proofs liegt, wodurch Daten verifiziert werden können, ohne sie zu entschlüsseln. Der auf Krypto spezialisierte Fonds Greenfield Capital sicherte sich hier gemeinsam mit Solana Ventures in frühen Runden mit einem Volumen von über 5 Millionen US-Dollar den Lead.

Gelato Network (Gründung 2020)

Hilmar Orth und Luis Schliesske agieren mit Gelato Network tief im Maschinenraum des Web3. Ihr B2B-Geschäftsmodell ist ein Automatisierungs- und Relayer-Netzwerk. Der USP besteht darin, dass Entwickler über Gelato Smart Contracts automatisieren und sogenannte Rollup-as-a-Service-Lösungen nutzen können – es ist quasi das AWS-Backend für dApps. Die Vision überzeugte Top-Fonds wie Dragonfly und IOSG Ventures, die Kapital in zweistelliger Millionenhöhe bereitstellten.

Unstoppable Finance (Gründung 2021)

Das Berliner Start-up Unstoppable Finance startete unter den Gründern Peter Großkopf, Maximilian von Wallenberg und Omid Aladini ursprünglich mit einer B2C-DeFi-Wallet. Nach einem radikalen strategischen Pivot und dem operativen Ausstieg von Großkopf im Jahr 2024 wandelten Wallenberg und Aladini das Modell erfolgreich zu einer B2B-Infrastruktur für Stablecoins. Der starke USP ist der Aufbau einer vollumfänglich regulierten Brücke („Swift 2.0“), die es institutionellen Kunden vereinfacht, Stablecoins nahtlos in ihre traditionellen Produkte einzubinden. Lightspeed Venture Partners und Speedinvest führen hier das Cap Table mit einem 12,5-Millionen-Dollar-Investment an.

Senken (Gründung 2022)

Das Gründerteam um Adrian Wons, René Schäfer und Djamel Mekibes verknüpft Blockchain mit echtem Klimaschutz. Sie bauen einen B2B-Marktplatz für den Handel mit tokenisierten CO2-Zertifikaten (Carbon Credits). Der USP dieses Regenerative Finance (ReFi) Modells ist die absolute Transparenz und Nachverfolgbarkeit von Klimakompensationen, die das Double-Spending-Problem klassischer Zertifikate eliminiert. Obvious Ventures und namhafte Krypto-Fonds investierten frühzeitig in Senken rund 7,5 Millionen US-Dollar.

Internationaler Ausblick & Fazit

Der Blick über die europäischen Grenzen zeigt, dass die Innovationszyklen rasant bleiben. Aus den USA schwappt aktuell der Makro-Trend der „Chain Abstraction“ zu uns herüber: Blockchain-Technologie wird im Backend so unsichtbar, dass Nutzer*innen gar nicht mehr wissen, auf welchem Netzwerk sie sich bewegen – ähnlich wie heute niemand mehr TCP/IP versteht, um das Internet zu nutzen.

Gleichzeitig forcieren asiatische Märkte, allen voran Singapur und Hongkong, mit massiven staatlichen Förderungen die Verschmelzung von KI-Agenten und Krypto-Payments. Zudem zwingt die globale Entwicklung von digitalen Zentralbankwährungen (CBDCs) die Finanzsysteme endgültig zur Modernisierung.

Für Gründer*innen und Investor*innen lautet das aktuelle Fazit daher so simpel wie hart: Wer heute in der Blockchain-Branche überleben will, muss bauen wie ein traditionelles Softwareunternehmen – besessen davon, echte, drängende Probleme der Wirtschaft zu lösen, nur eben mit einer radikal überlegenen, dezentralen Architektur.

Diingu: Kampf gegen den Fachkräftemangel im Sozialwesen

Das Diingu-Gründerteam aus Frankfurt will den eklatanten Fachkräftemangel im Sozialwesen mit einer digitalen Lern- und Jobplattform bekämpfen. Das Start-up hat namhafte Träger*innen an Bord und spricht nun mit internationalen Investor*innen. Doch wie tragfähig ist das Geschäftsmodell in einem chronisch unterfinanzierten Markt, und wie realistisch sind die europäischen Skalierungsträume? Wir haben nachgefragt.

Wer sich den Pitch von Sahm Shojai, Geschäftsführer der Frankfurter Diingu GmbH, durchliest, spürt schnell den typischen Start-up-Idealismus. Es geht um „konkrete Wirkung“, „soziale Teilhabe“ und die Vision einer „globalen sozialen Infrastruktur“, um weltweit die Lebensrealität von Kindern zu verbessern. Das klingt zweifellos gut im Pitch-Deck für potente VCs. Doch zieht man die schillernde Marketing-Ebene ab, bleibt ein konkretes und weitaus pragmatischeres Kerngeschäft. Diingu ist im Kern eine E-Learning- und Recruiting-Plattform für pädagogische Assistenzkräfte. Es handelt sich um ein klassisches B2B2C-Modell in einer Nische, die von der Digitalisierung bislang stiefmütterlich behandelt wurde.

Vom Bruder-„Frust“ zum Uni-Spin-off

Die Geschichte von Diingu – kurz für Digital Inclusion Guide – beginnt im echten Leben. Der Bruder von Mitgründer Sahm Shojai arbeitete als Schulbegleiter und berichtete von den massiven Herausforderungen in seinem Job. Das grundlegende Problem: Immer mehr ungelernte Quereinsteiger*innen strömen in die soziale Branche, denen es eklatant an fachlicher Einarbeitung, Fortbildungen und Qualitätsstandards mangelt.

Aus diesem Engpass formten Sahm Shojai und seine Mitgründer Felix Kolb und Florian Kranz eine digitale Lösung. Dabei gingen sie methodisch klug vor und holten sich von Beginn an wissenschaftliche Expertise ins Boot. Unter der Mentorenschaft von Prof. Dr. Wolfgang Dworschak vom Lehrstuhl für Pädagogik bei geistiger Behinderung an der Universität Regensburg wurde das Start-up als Ausgründung der Hochschule etabliert. Das sicherte dem Team nicht nur ein exist-Gründerstipendium, sondern 2023 auch den Hochschulgründerpreis sowie den 2. Platz beim Frankfurter Gründerpreis. Die Plattform profitiert stark von diesem Fundament, denn die Inhalte sind keine bloßen Wikipedia-Zusammenfassungen, sondern wissenschaftlich fundierte, praxisnahe Kurse.

Doch wie stellt das Team sicher, dass das akademische Wissen der Uni Regensburg nicht zu theoretisch ist und an der rauen Realität einer überforderten Hilfskraft in einer Brennpunkt-Schule vorbeigeht? „Die Entwicklung der Kursinhalte findet mit sorgfältig ausgewählten Experten und Expertinnen statt“, versichert Shojai. Diese verfügten nicht nur über den nötigen akademischen Bezug, sondern brächten auch umfassende praktische Erfahrung mit. „Wir geben klare Richtlinien für die sprachliche Ausgestaltung der Kurse vor und legen großen Wert darauf, dass der Fokus auf praxisnahen Inhalten liegt“, betont der Gründer.

Um die Theorie-Praxis-Lücke zu schließen, fließen daher neben Fachliteratur vor allem persönliche Praxiserfahrungen in die Entwicklung ein. Zudem belässt es Diingu nicht bei der Uni Regensburg, die primär mit Forschungsarbeiten die Qualität sichert. Man kooperiert laut Shojai ebenfalls mit der LMU München, wo der Schwerpunkt auf formativer Diagnostik und Monitoring-Services liege. „Gemeinsam entwickeln wir beispielsweise aktuell ein KI-Tool, das Verhalten- und Risikoanalysen bei Kindern und Jugendlichen durchführen kann“, kündigt der Geschäftsführer an. Sozialarbeitende sollen dadurch befähigt werden, Kindeswohlgefährdungen besser zu erkennen. „Diese innovativen Services sollen den Arbeitsalltag professionalisieren“, resümiert er.

E-Learning trifft auf Jobbörse

Diingu fungiert als zweiseitiger Marktplatz. Auf der einen Seite stehen Privatpersonen wie Schulbegleitende, Kita-Kräfte oder Familienhelfer*innen. Sie können sich gegen eine monatliche Gebühr von aktuell 15 Euro flexibel über mehr als 70 Online-Kurse zu Themen wie Autismus oder ADHS weiterbilden. Bei Verständnisfragen hilft ein KI-Chatbot. Mit den erworbenen Zertifikaten bauen sich die Nutzer*innen dann ein digitales Profil auf. Auf der anderen Seite stehen die großen Träger wie das DRK, die Johanniter oder die Lebenshilfe. Sie zahlen für jährliche Lizenzen, um ihr bestehendes Personal digital zu schulen, Nachweise zentral zu verwalten und schlichtweg Verwaltungskosten zu sparen.

Hand aufs Herz: Wie viele der ohnehin meist schlecht bezahlten pädagogischen Hilfskräfte zahlen die 15 Euro im Monat wirklich selbst aus eigener Tasche? Und plant Diingu langfristig nicht doch einen kompletten Pivot zum lukrativeren, reinen B2B-Modell? Shojai holt bei dieser Frage etwas weiter aus: Man sei vor rund drei Jahren ursprünglich als reine Lernplattform im B2B-Bereich gestartet. Träger nutzten die Kurse zur Schulung des eigenen Personals. „Mit der Zeit erhielten wir jedoch auch zunehmend Anfragen von Privatpersonen, die sich mit unseren Inhalten weiterbilden möchten, um sich auf einen Job im sozialen Bereich zu bewerben“, blickt er zurück. Daraufhin habe man dasselbe Lernangebot über eine App auch für B2C-Kund*innen geöffnet, um die berufliche Vorqualifizierung zu ermöglichen. Gleichzeitig wurde die Jobplattform gelauncht, um beide Kund*innengruppen zusammenzubringen.

Auf die Skepsis bezüglich der privaten Zahlungsbereitschaft kontert Shojai selbstbewusst: „Das sind Menschen, die einen Job im sozialen Bereich suchen und davon gibt es viele, weil der Fachkräftemangel eine sehr hohe Nachfrage nach beruflicher Weiterbildung erzeugt.“ Er spricht im gleichen Atemzug gar von einer handfesten Marktdisruption. Klassische Fortbildungen zur Schulbegleitung kosteten bei anderen Bildungsträgern schnell zwischen 800 und 1.200 Euro. Dies werde heute meist über Bildungsgutscheine finanziert.

Doch genau hier wittert Diingu seine strategische Chance: „Diese Finanzierung über Bildungsgutscheine wird sich mit der Grundsicherung ab Juli 2026 ebenfalls verändern“, prognostiziert Shojai. Aufgrund des Vermittlungsvorrangs würden die Gutscheine künftig nicht mehr so großzügig vergeben. Diingu hingegen biete Wissen für zahlreiche Berufe bereits ab 15 Euro an. „Mit anderen Worten: Wir haben diesen Markt demokratisiert und Wissen überhaupt erst auf Selbstzahlerbasis bezahlbar gemacht“, stellt er klar. Selbst ohne große Werbung könne man erste bezahlte Abonnements vorweisen. „In den kommenden Monaten planen wir, größere Kampagnen zu launchen und mittelfristig den B2B2C-Weiterbildungsmarkt für soziale Berufe mit unserem Selbstzahler-Konzept und unserem E-Learning-Ansatz zu übernehmen“, gibt sich der Geschäftsführer kämpferisch.

Der eigentliche Clou – und das potenzielle Schwungrad des Geschäftsmodells – ist jedoch die Verzahnung: Träger können über das Diingu-Jobportal direkt auf die vorqualifizierten Privatnutzer zugreifen und diese rekrutieren. Doch die großen Wohlfahrtsverbände gelten oft als extrem schwerfällig in der Digitalisierung. Wie hart war es, Traditionsverbände wie das DRK davon zu überzeugen, ihr Recruiting über ein noch unbekanntes Start-up abzuwickeln? Shojai räumt ein, dass die Anfangszeit kein Selbstläufer war. „Digitalisierung bedeutete für viele im sozialen Bereich vor allem Veränderung“, analysiert er. „Und Veränderungen vermeidet man gern, solange nichts anbrennt.“ Heute punkte man schlichtweg mit einem guten Service zum erschwinglichen Preis, weshalb immer mehr große Träger Diingu ausprobieren wollten. Die Einführung bei den Platzhirschen erfordere natürlich Prozessumstellungen, was aber branchenübergreifend bei Großunternehmen der Fall sei. Dennoch gibt der Gründer zu: „Aber ja, keine Frage: Sales war bisher die größte Herausforderung in diesem Unternehmen.“ Das Geschäftsmodell und die Verkaufsstrategien mussten mehrfach nachgeschärft werden. Heute, so Shojai, sei es aber „deutlich einfacher geworden als noch zu Beginn“.

Markt & Wettbewerb

Der Markt für soziale Dienstleistungen ist riesig, aber extrem komplex. Der Fachkräftemangel ist immens; Träger müssen notgedrungen auf ungelernte Hilfskräfte zurückgreifen, was unweigerlich die Qualität der Betreuung gefährdet. Hier trifft Diingu einen echten Pain Point. Der Wettbewerb besteht derzeit vor allem aus den analogen Akademien der Wohlfahrtsverbände, regionalen Fortbildungsanbietern und stark generalisierten E-Learning-Plattformen. Auch klassische Recruiting-Plattformen mischen mit. Diingu grenzt sich durch die spitze Zielgruppe rund um Inklusion und Schulbegleitung sowie durch die intelligente Kombination aus Qualifizierung und Recruiting ab.

Skalierungsträume vs. Marktrealität

So lobenswert der Ansatz ist, das Geschäftsmodell muss sich im Härtetest einigen kritischen Fragen stellen. Ein massives Problem ist der Markt als regulatorischer Flickenteppich. Diingu spricht aktuell mit Investor*innen, um europaweit zu skalieren, doch das Sozial- und Bildungswesen ist hochgradig lokalisiert. Da sich die Vorgaben für Inklusion in Deutschland bereits von Bundesland zu Bundesland massiv unterscheiden, bedeutet eine europäische Expansion zwingend, dass Fortbildungsinhalte an völlig andere gesetzliche Rahmenbedingungen angepasst werden müssen. Das kostet enorm viel Zeit und verbrennt Kapital.

Wie will Diingu diese gewaltige regulatorische Wand durchbrechen, ohne sich finanziell und personell zu verheben? „Das ist eigentlich die entscheidendste Frage, und genau diese begleitet uns seit fast zwei Jahren“, gibt Shojai offen zu. Mit der Lösung stehe und falle der internationale Erfolg. Die Antwort des Start-ups lautet: Automatisierung. Man entwickle gerade eine zweigeteilte „Kursfabrik“. Eine Abteilung konzipiere kleinere Kurse mithilfe von Künstlicher Intelligenz, die am Ende lediglich von Expert*innen lektoriert und qualitätsgeprüft werden. Dafür habe man eigens eine von AWS geförderte Kooperation zur Entwicklung generativer KI-Anwendungen gestartet, um einen skalierbaren Workflow zu etablieren.

Große und wichtige Kurse bleiben jedoch Handarbeit nach strengen Richtlinien. „KI kommt da nicht hin, und ihr fehlt auch reales Praxiswissen, das nur ausgewählte Expertinnen und Experten mitbringen“, stellt Shojai klar. Diese Zweiteilung bedingt logischerweise extrem hohe Kosten bei der Lokalisierung der Inhalte. Auf die konkrete Frage nach der Finanzierbarkeit bleibt der Gründer allerdings unkonkret. Man habe zwar bereits eine „finanzstrategische Lösung“ erarbeitet, doch Details wolle er zum jetzigen Zeitpunkt noch nicht verraten. Er gibt sich jedoch siegessicher: „Wir glauben, mit diesem hybriden KI-Mensch-Kursentwicklungsansatz einen entscheidenden Wettbewerbsvorteil zu erlangen.“

Gleichzeitig stößt das Modell unweigerlich an die Grenzen der Digitalisierung. Das Start-up wirbt mit einem KI-Guide, in der sozialen Arbeit gilt jedoch unumstößlich das Credo: Beziehung vor Technik. Empathie, Deeskalation und der Umgang mit schwer beeinträchtigten Kindern lassen sich über Klick-Kurse und KI-Chats nur in der grauen Theorie erlernen. Eine reine Digitalisierung der Fortbildung ersetzt keine Praxisbegleitung im wahren Leben.

Abschließend wirft auch das avisierte „Big Picture“ rund um die Vision „Diingu Care“ Fragen auf. Die Ankündigung, künftig weltweit Bildungsprojekte zu unterstützen, wirkt aktuell noch wie ein sehr ambitioniertes PR-Versprechen für Impact-Investor*innen. Für ein Start-up in der vulnerablen Skalierungsphase birgt ein solcher Nebenschauplatz stets die Gefahr, den Fokus auf das stark erklärungsbedürftige DACH-Kerngeschäft zu verlieren.

Lenkt diese noble globale Vision das Team nicht gefährlich vom eigentlichen Überlebenskampf und der schwierigen Marktdurchdringung in Europa ab? „Absolut“, stimmt Shojai überraschend direkt zu. Genau aus diesem Grund bewerbe man das Projekt derzeit weder öffentlich noch bei Investor*innen. „Es steht weder auf der Website noch auf irgendeinem Pitch Deck“, versichert er. Der Fokus liege aktuell ausschließlich auf dem Aufbau eines funktionierenden und stark wachsenden Geschäfts. „Erst wenn wir damit Investoren und auch uns selbst geholfen haben, können wir anfangen, mit Diingu Care anderen zu helfen“, erklärt Shojai sein strategisches Prinzip. Dennoch ist es ihm spürbar ein Anliegen zu betonen, dass Diingu Care keine hohle PR-Phrase sei. Diese globale Infrastruktur für Länder ohne stabile soziale Systeme werde unweigerlich kommen. „Und an diesem Ziel wird sich auch nichts ändern, nur weil es ambitioniert ist“, bekräftigt der Geschäftsführer abschließend. „Denn genau das soll Diingu ausmachen: eine Organisation, die Verantwortung übernimmt.“

Fazit

Diingu ist ein exzellentes Beispiel dafür, wie aus einem echten, greifbaren Alltagsproblem eine kluge SaaS-Lösung entstehen kann. Das Team hat durch die universitäre Anbindung seine Hausaufgaben gemacht und mit über 100 Trägern bereits beachtliche Traction im B2B-Markt erreicht. Der Weg zum europaweiten Skalierungserfolg oder gar zur „globalen sozialen Infrastruktur“ wird jedoch steinig. VCs werden künftig genau prüfen, ob die Margen im chronisch klammen Sozialsektor ausreichen und ob der stark regulierte Bildungsmarkt schnelle geografische Sprünge überhaupt zulässt. Diingu muss jetzt beweisen, dass es nicht nur ein nützliches Werkzeug für deutsche Wohlfahrtsverbände bietet, sondern das Zeug zu einem hochprofitablen, grenzüberschreitenden Plattformgeschäft hat.

Angriff auf die Giganten: Das Milliarden-Business mit dem „schnellen Teil“

Wie die SPAREPARTSNOW-Gründer Dr. Christian Hoffart und Sebastian Kleinschmager von München aus den Weltmarkt für Ersatzteile umkrempeln und US-Distributoren das Fürchten lehren wollen.

Ein defektes Bauteil, ein rauchendes Fließband und ein wirtschaftlicher Schaden von 100.000 Euro pro Tag: Der Albtraum eines jeden Werksleiters ist oft bittere Realität. Während der private Konsum längst im „Next-Day-Zeitalter“ angekommen ist, glich die Beschaffung von Industrieteilen bisher einer archäologischen Expedition durch verstaubte Fax-Listen und intransparente Händlerstrukturen. Das Münchner Start-up SPAREPARTSNOW beendet diese Ära nun endgültig und beweist, dass „DeepTech made in Germany“ das Zeug zur globalen Disruption hat.

Die Geburtsstunde einer Milliarden-Idee

Trotz Industrie 4.0 scheiterte der Maschinenbau bisher oft an einer simplen Hürde: der Ersatzteil-Logistik. Zwischen dem Originalhersteller (OEM) und dem Endkunden in den USA oder Asien lagen meist drei bis fünf Zwischenstationen. Jede dieser Stationen kostete wertvolle Zeit und schlug massive Margen auf das Produkt auf. Die Folge war ein absurdes Ungleichgewicht: Ein in Deutschland produziertes Bauteil kam im Ausland oft mit Wochen Verspätung und zum doppelten Preis an.

Hier setzten Dr. Christian Hoffart und Sebastian Kleinschmager im Jahr 2022 an. Ihre Vision war so simpel wie radikal: Die Disintermediation – das radikale Ausschalten des Zwischenhandels. SPAREPARTSNOW verbindet die Industrie-Giganten direkt mit den Fabrikhallen weltweit. Was 2022 mit 20.000 Artikeln begann, ist bis heute – im Februar 2026 – auf ein digitales Ökosystem von über 5 Millionen Ersatzteilen angewachsen.

Der technologische Kraftakt hinter dem Wachstum

Für StartingUp-Leser*innen ist besonders die Skalierung interessant. Von 20.000 auf 5 Millionen Teile zu wachsen, ist kein reiner Vertriebserfolg, sondern eine technologische Meisterleistung. Während Sebastian Kleinschmager im Hintergrund die KI-gestützten Identifikationsalgorithmen verfeinerte, die heute selbst unscharfe Fotos von Bauteilen in Millisekunden zuordnen, musste das Team die Datenhoheit der oft skeptischen OEMs gewinnen.

Strategischer Meilenstein: Frontalangriff auf Nordamerika

Im Februar 2026 steht SPAREPARTSNOW vor seinem bisher kühnsten Schritt: dem Markteintritt in Nordamerika. Die Strategie ist ein Frontalangriff auf etablierte US-Distributoren. Durch die direkte OEM-Anbindung bietet SPAREPARTSNOW europäische Top-Marken in den USA zu Preisen an, die 20 bis 50 Prozent unter dem bisherigen US-Marktniveau liegen. Der „Transatlantik-Express“ garantiert zudem, dass ein Bauteil aus Süddeutschland oft schon am nächsten Werktag in einer US-Fabrik eintrifft. Geschwindigkeit ist hier die einzige Währung, die gegen den drohenden Stillstand hilft.

München oder Silicon Valley?

Trotz der globalen Ambitionen bleibt SPAREPARTSNOW fest in der bayerischen Landeshauptstadt verwurzelt. In einer Welt, in der Start-ups oft schielten, sobald das erste Wagniskapital aus den USA winkte, blieb das Team dem Standort München treu. Hier sitzt die Kompetenz des Maschinenbaus, hier ist die Nähe zu den Herstellern – ein strategischer Vorteil, den kein Algorithmus der Welt ersetzen kann.

Die Zukunft der globalen Instandhaltung

Mit dem Rollout in den USA und dem geplanten Sprung nach Südostasien im dritten Quartal 2026 schließt sich der Kreis zu einem globalen Netzwerk. SPAREPARTSNOW beweist, dass Mut zur Lücke und technologische Tiefe ausreichen, um jahrzehntealte Monopole aufzubrechen. Durch die Kombination aus radikaler Preistransparenz, KI-gestützter Teilesuche und einer Logistik, die Kontinente in Stunden überbrückt, schafft das Unternehmen einen fundamentalen Fortschritt für die weltweite Industrie. In einer Zeit, in der Resilienz und Schnelligkeit über die Wettbewerbsfähigkeit ganzer Wirtschaftsstandorte entscheiden, wird SPAREPARTSNOW vom bloßen Marktplatz zum unverzichtbaren Rückgrat einer digitalisierten, globalen Produktion, die nicht nur schneller und günstiger, sondern durch die Integration von Refurbished-Teilen und reduzierten Lagerwegen auch nachhaltiger agiert.

Über den Wolken, aber digital

Wie das 2020 von Heinz Koop gegründete Aviation Hero den verstaubten Markt der Flugausbildung aufmischt.

Die Ausbildung zum/zur Privatpilot*in galt jahrzehntelang als zeitaufwendig, wenig flexibel und extrem papierlastig. Wer fliegen lernen wollte, musste sich den rigiden Zeitplänen traditioneller Flugschulen unterordnen oder am Wochenende im Aeroclub Arbeitsstunden ableisten. Das Monheimer Start-up Aviation Hero tritt an, um genau diesen Schmerzpunkt zu lösen. Mit dem Claim, „Deutschlands erste volldigitale Flugschule“ zu sein, hat das Unternehmen eine stark regulierte Nische digitalisiert. Wir werfen einen genaueren Blick auf das gebootstrappte Geschäftsmodell, das EdTech mit Luftfahrtrecht verbindet.

Das geht besser!

Hinter Aviation Hero steht der Gründer Heinz Koop. Als er 2018 selbst enthusiastisch seine Ausbildung zum Privatpiloten (PPL) begann, stieß er schnell auf die harte Realität der Branche: trockener Theorieunterricht, unflexible Strukturen und eine hohe Abbruchquote bei den Flugschüler*innen. Aus diesem Negativerlebnis heraus entstand die Geschäftsidee. Im Jahr 2020, mit gerade einmal 22 Jahren, brach Koop sein Studium ab und gründete die Aviation Hero GmbH.

Bemerkenswert in der heutigen Start-up-Landschaft: Das Unternehmen ist zu 100 Prozent gebootstrappt. Anstatt auf Risikokapitalgeber*innen zu setzen, finanzierte Koop das Projekt aus eigenen Mitteln und baute das Angebot organisch auf. Ein massiver Wachstumstreiber war dabei Social Media. Mit einem YouTube-Kanal, der mittlerweile über 14.000 abonnierende Luftfahrt-Enthusiast*innen zählt, schuf sich Koop eine eigene Vertriebs-Pipeline und wurde zum Gesicht der modernen Pilotenausbildung in Deutschland.

„Ein Marathon ohne sichtbare Ziellinie“

Dass der Aufbau eines Unternehmens in einem extrem kapitalintensiven Markt ohne externes Geld kein Spaziergang ist, musste Koop schnell feststellen. „Es gab nicht den einen Tiefpunkt, sondern mehrere Phasen, in denen ich kurz davor war aufzuhören“, erinnert sich der Gründer. Ein besonders kritischer Moment ereignete sich kurz vor dem Launch des ersten Theoriekurses. Die Teilnehmer*innen hatten bereits bezahlt, als der fest eingeplante Fluglehrer plötzlich per Telefon absagte – ausgerechnet, als Koop sich wegen gesundheitlicher Probleme auf einer Ayurveda-Kur in Indien befand.

„Ich stand irgendwo am Strand in Indien, hatte Kunden, die sich auf den Kurs freuten, und keinen Fluglehrer mehr“, beschreibt er die absurde Situation. „Kein Investor, kein Sicherheitsnetz, kein Team das auffängt – alles hing an mir.“ Den Kurs abzusagen, kam für ihn jedoch nicht infrage. Nach unzähligen Telefonaten aus Indien fand er schließlich einen Ersatz, der den Kurs letztlich sogar noch besser betreute. Was ihn in diesen harten Momenten antrieb? „Was mich in solchen Momenten immer zum Weitermachen motiviert hat, waren die Nachrichten von Flugschülern“, betont Koop. Wenn Zweifel aufkamen, las er Nachrichten wie: „Heinz, ohne euch hätte ich meinen Traum nie verwirklicht.“ Seine wichtigste Lektion für andere Gründer*innen lautet daher: „Du brauchst nicht den perfekten Businessplan – du brauchst direktes Kundenfeedback, das dir zeigt, dass das, was du baust, einen echten Unterschied macht. Das ist dein Treibstoff, wenn alles andere wegbricht.“

EdTech im Cockpit

Heute ist Aviation Hero vom Luftfahrt-Bundesamt bzw. der Bezirksregierung als Declared Training Organization offiziell zertifiziert. Das Kerngeschäft ist der Verkauf von digitalen Ausbildungspaketen für angehende Privatpilot*innen, allen voran das Sprechfunkzeugnis („BZF Mastery“) sowie Theorie-Crashkurse für die Lizenzen LAPL und PPL.

Die methodische Umsetzung erinnert dabei an moderne EdTech-Plattformen und kombiniert hochwertig animierte Videolektionen, die Netflix-ähnlich konsumiert werden können, mit interaktiven Live-Q&A-Sessions via Zoom und einer Community-Plattform namens Skool für den direkten Austausch.

Dass die konservativen Luftfahrtbehörden diesen digitalen Ansatz absegneten, war laut Koop weniger ein Kampf als oft vermutet. „Ehrlicherweise war der Ansatz gar nicht so radikal, wie er von außen wirkt“, wiegelt er ab. Zugelassene Fernlehrgänge gab es bereits, doch bestanden diese oft aus endlosen Textwüsten ohne Support. „Wir haben uns gefragt: Wie können wir die Vorteile aus beiden Modellen kombinieren? Herausgekommen ist der Aviation Hero Ansatz“, erklärt Koop.

Die eigentliche Herausforderung sei nicht die Behördenüberzeugung gewesen, sondern die Produktion von Hunderten Videolektionen und der Aufbau der eigenen Methodik. Als das Konzept stand, erkannte die Bezirksregierung in Düsseldorf schnell den Mehrwert. „Die Zusammenarbeit ist seitdem konstruktiv und vertrauensvoll“, versichert der Gründer.

Digitale Disruption gegen E-Learning-Dinosaurier

Der Markt für Flugausbildungen im DACH-Raum ist extrem stark fragmentiert. Neben Hunderten lokalen Flugvereinen gibt es etablierte Branchenriesen wie CAT oder Cranfield Aviation. Doch diese Platzhirsche dominieren primär als B2B-Zulieferer und bieten den Schüler*innen oft textlastiges E-Learning der alten Schule. Aviation Hero fischt hier in einem „Blue Ocean“, indem das Start-up die Endkund*innen (B2C) direkt und professionell über Performance Marketing anspricht.

Wird das Start-up in der traditionellen Branche als feindlicher Disruptor oder als dringend benötigter Modernisierer wahrgenommen? „Beides – und es hängt davon ab, wen du fragst“, räumt Koop ein. Zwar höre er regelmäßig skeptische Stimmen, die auf reinen Präsenzunterricht pochen, doch viele Flugschulen sähen Aviation Hero längst als wertvolle Ergänzung. „Unsere Teilnehmer kommen mit bestandenem BZF und bestandener Theorie zu ihnen – und können vom ersten Tag an das Wetterbriefing lesen, den Funk machen und die Lufträume verstehen“, erklärt er den Vorteil für die Praxis-Schulen. Sein klares Credo: „Wir wollen nicht gegen die Branche arbeiten, sondern mit ihr – aber auf einem modernen Level.“

Wo sind die Turbulenzen?

Trotz über 2.000 begleiteter Schüler*innen gibt es auch Herausforderungen. Die Luftfahrt ist eine der am stärksten reglementierten Branchen der Welt. So verbieten EASA-Richtlinien ein reines Netflix-Modell und fordern einen Anteil an synchronem, betreutem Unterricht von etwa zehn Prozent. Auch Prüfungen müssen physisch bei der Bezirksregierung oder der Bundesnetzagentur abgelegt werden.

Zudem sorgt das Aviation-Hero-Preismodell im Premium-Segment gelegentlich für Diskussionsstoff. Die Kritik: Der reguläre Zugang ist auf vier Monate begrenzt; wer länger braucht, muss monatliche Verlängerungsgebühren zahlen. Auf den Vorwurf eines reinen „Penalty-Pricings“ zur Profitsteigerung reagiert Koop jedoch entschieden: „Die zeitliche Begrenzung ist ein bewusster Teil unseres Ausbildungskonzepts – und zwar im Interesse der Teilnehmer.“

Vor dem Start erarbeite man in kostenlosen Zoom-Gesprächen einen klaren Fahrplan, sodass volle Transparenz herrsche. „Warum überhaupt ein Zeitrahmen? Weil der gefährlichste Fehler in der Flugausbildung ein Projekt ohne Deadline ist“, warnt der junge Unternehmer eindringlich. Zu oft meldeten sich Flugschüler*innen motiviert an, verlören sich dann aber im Alltag. „Wer sich BZF und Theorie über viele Monate streckt, braucht exponentiell mehr Zeit, weil man sich jedes Mal wieder neu in die Themen reindenken muss“, analysiert Koop. Der Fokus auf einen kompakten Zeitraum sei schlichtweg pädagogisch sinnvoller.

Fazit & Ausblick

Letztlich verlagert eine digitale Theorie-Ausbildung den Flaschenhals auf die praktische Umsetzung im Cockpit, wo schlechtes Wetter oder fehlende Fluglehrerinnen drohen. Hier setzt Aviation Hero mit dem neuen „Praxis Sprint“ an. Gemeinsam mit einer Partnerflugschule in Hannover können Schüler*innen die komplette praktische Ausbildung in nur vier Wochen durchziehen. „BZF und Theorie online in drei Monaten, Praxis in einem Monat – die komplette Privatpilotenlizenz in zirka vier Monaten möglich. Das gibt es in Deutschland in dieser Form sonst nirgends“, verspricht Koop. Für die künftige Skalierung setzt er massiv auf den Ausbau dieses Partnernetzwerks. Flugschulen schicken ihre Schüler*innen für die Theorie zu Aviation Hero, und das Start-up vermittelt sie für die Praxis zurück.

Trotz des schnellen Wachstums bleibt der Gründer bodenständig: „Wir sind gebootstrappt und wachsen organisch. Das heißt: Wir machen den nächsten Schritt erst, wenn der aktuelle wirklich sitzt.“ Das Start-up beweist eindrucksvoll: Selbst in einer stark regulierten und verstaubten Branche kann der radikale Fokus auf digitale Nutzer*innenerfahrung Marktführer hervorbringen. Die spannendste Frage wird nun sein, wie reibungslos Aviation Hero in Zukunft die physischen Flugstunden für seine wachsende Schüler*innenschaft skalieren kann.

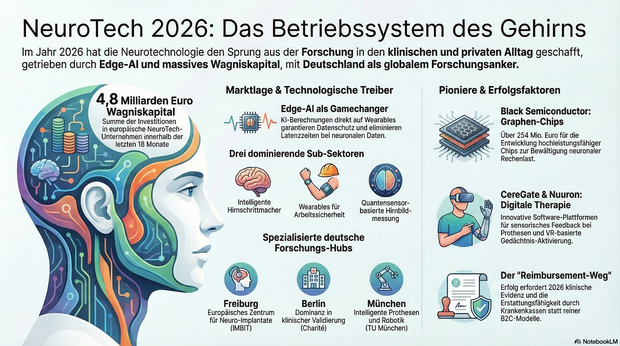

NeuroTech-Start-up-Report 2026

Das Betriebssystem des Gehirns: Wie NeuroTech die Grenze zwischen Mensch und Maschine auflöst und welche Start-ups dabei hierzulande federführend sind.

Der Moment, in dem eine gelähmte Person allein durch die Kraft ihrer Gedanken einen digitalen Cursor bewegt oder eine mechanische Prothese steuert, ist im Jahr 2026 längst kein Labor-Wunder mehr, sondern der Startpunkt einer industriellen Revolution. Wir befinden uns am Beginn des „Century of the Brain“. Pioniere wie das Münchner Scale-up munevo (gegründet 2018), das mit Smart-Glass-Steuerungen für Rollstühle Weltmarktführer wurde, oder die Freiburger Implantat-Spezialist*innen von CorTec (gegründet 2010), haben das technologische Fundament gegossen. Doch die neue Generation, die wir heute sehen, macht Neurotechnologie massentauglich und überführt sie aus der universitären Forschung in den klinischen und privaten Alltag.

Die Marktlage 2026

Der Markt hat 2026 eine neue Reifephase erreicht, maßgeblich getrieben durch Edge-AI. Bei dieser Technologie finden die komplexen KI-Berechnungen direkt auf dem Chip des Wearables statt, was Latenzzeiten eliminiert und die sensiblen neuronalen Daten lokal schützt. Branchenschätzungen auf Basis vergangener KfW-Innovationspanels deuten darauf hin, dass in den letzten 18 Monaten über 4,8 Milliarden Euro an Wagniskapital in europäische NeuroTech-Unternehmen geflossen sind. Zudem gehen Prognosen aus dem Umfeld von Branchenverbänden wie dem Bitkom davon aus, dass künftig jedes fünfte deutsche DeepTech-Start-up im Bereich Life Sciences neuronale Daten als Kernbestandteil seines Geschäftsmodells nutzen wird. Series-B-Runden unter 50 Millionen Euro sind bei technologischen Marktführer*innen mittlerweile die Ausnahme, da die regulatorischen Hürden der MDR (Medical Device Regulation) – der strengen EU-Verordnung für Medizinprodukte – enorme Kapitalpuffer für langwierige klinische Studien erfordern.

Jenseits von Neuralink: Die neuen Treiber der Branche

Drei technologische Sub-Sektoren dominieren das Jahr 2026. An vorderster Front steht die Closed-Loop-Neurostimulation, also „intelligente“ Hirnschrittmacher, die neuronale Biomarker in Echtzeit messen und Stimulationen (etwa bei Parkinson) nur dann auslösen, wenn das Gehirn sie wirklich benötigt. Ein weiterer Treiber sind Neuro-Wearables für die Arbeitssicherheit, die kognitive Überlastung messen, bevor menschliches Versagen zu Unfällen führt. Den dritten Block bildet das OPM-MEG (Optically Pumped Magnetometer-Magnetoencephalography). Diese neue Form der Hirnbildmessung nutzt Quantensensoren in leichten Helmen statt tonnenschwerer MRT-Geräte, um Demenz-Muster millimetergenau bei Raumtemperatur zu identifizieren.

Reality Check

Der Weg zum neuronalen Einhorn ist mit gescheiterten Hoffnungen gepflastert. Ein prominentes Mahnmal bleibt der Fall von Halo Neuroscience, die mit „Neuropriming“-Headsets für Sportler*innen einen Hype auslösten, aber letztlich an der mangelnden klinischen Evidenz scheiterten. Daraus hat die Branche vier fatale Fallstricke gelernt: Die Unterschätzung der klinischen Validierung, die Vernachlässigung der „Neuro-Ethics“ (Datensouveränität im Gehirn), das „Plattform-Paradoxon“ (Hardware ohne Software-Ökosystem) und der Versuch eines reinen B2C-Markteintritts ohne ärztliche Einbindung. Gründerinnen, die 2026 bestehen wollen, müssen den „Reimbursement-Weg“ über die Krankenkassen meistern.

Deutsche Brain-Hubs

Deutschland hat sich 2026 als globaler Forschungsanker etabliert. Freiburg bleibt durch das IMBIT das europäische Zentrum für Neuro-Implantate, während Berlin mit der Charité die klinische Validierung dominiert. München nutzt seine Stärke in der Robotik rund um die TU München für intelligente Prothesen, während in Karlsruhe am KIT ein Cluster für KI-basierte Diagnose-Algorithmen entstanden ist. Dresden fungiert derweil durch seine Mikroelektronik-Expertise als die „Werkbank“ für die hochspezialisierten Neuro-Chips der nächsten Generation.

Investor*innen-Radar

Die Finanzierungslandschaft ist 2026 hochgradig spezialisiert. Bei den VCs führen Fonds wie EQT Life Sciences (ehem. LSP) und Kurma Partners das Feld an, während Generalistinnen wie Lakestar oder HV Capital gezielt die Schnittstelle zwischen NeuroTech und generativer KI besetzen. Auf der Corporate-Ebene agieren die Investmentarme von Medtronic und Siemens Healthineers als strategische Anker. In der Frühphase sind es oft erfahrene Gründerinnen als Business Angels oder spezialisierte Syndikate wie die DeepTech Stars, die die ersten Millionen-Tickets lösen.

Diese NeuroTech-Start-ups solltest du 2026 auf dem Radar haben

Für die Auswahl der folgenden Start-ups wurden Unternehmen analysiert, die maximal sieben Jahre alt sind und mindestens TRL 6 (Technology Readiness Level 6) erreicht haben. Das bedeutet, die Technologie wurde bereits erfolgreich in einer klinisch relevanten Umgebung demonstriert. Weitere Kriterien waren die Patentdichte, die Validität des Geschäftsmodells sowie das Vertrauen führender MedTech-Investor*innen im Jahr 2025/26.

Black Semiconductor

Angeführt wird dieses Feld von Black Semiconductor aus Aachen, das 2020 von den Brüdern Dr. Daniel und Sebastian Schall gegründet wurde. Sie entwickeln Graphen-Chips – Halbleiter auf Basis von Kohlenstoff-Nanostrukturen, die Daten optisch übertragen und so künftig die enorme Rechenlast neuronaler KI bewältigen sollen. Ihr Geschäftsmodell basiert auf Deep-Tech-Hardware, gestützt durch eine Gesamtfinanzierung von über 254 Millionen Euro. Der Großteil davon (rund 229 Millionen Euro) stammt aus öffentlichen Förderprogrammen, ergänzt durch privates Kapital von Lead-Investor*innen wie Porsche Ventures und Project A. Gegenwärtig liegt der Fokus des Unternehmens auf der Validierung seiner neuen 300-mm-Wafer-Pilotfertigungslinie („FabONE“) in Aachen. Die Graphen-Technologie besitzt dabei das physikalische Potenzial, die Energieeffizienz und Übertragungsgeschwindigkeit gegenüber herkömmlichen Silizium-Chips massiv zu steigern.

CereGate

In München setzt CereGate, gegründet von Dr. Bálint Várkuti, neue Maßstäbe durch eine Software-Plattform, die Informationen direkt in das Gehirn „einschreibt“, um etwa sensorisches Feedback für Prothesen zu generieren. Ihr B2B-Software-Modell zielt auf Partnerschaften mit großen Implantat-Hersteller*innen ab und wird unter anderem von 468 Capital sowie re.Mind Capital unterstützt. Momentan bereitet das Team klinische Studien vor, um die strengen Anforderungen der europäischen Medizinprodukteverordnung (MDR) zu erfüllen. Ein zentraler Fokus liegt dabei auf der zukünftigen Behandlung von Parkinson-Gangstörungen, für die das Unternehmen mittelfristig eine entsprechende Zertifizierung und den Marktzugang anstrebt.

MindAhead

Den Bereich der Demenz-Prävention besetzt MindAhead aus Berlin, das 2022 unter anderem von Nina Kiwit und Pasquale Fedele ins Leben gerufen wurde. Ihre KI-Plattform zur Früherkennung und Verlangsamung kognitiven Abbaus wird durch den Roche-Partner RoX Health validiert. In dieser Phase konzentriert sich das Start-up auf die klinischen Studien für die offizielle Listung als dauerhafte DiGA (Digitale Gesundheitsanwendung). Ziel ist es, nach erfolgreicher Zulassung allen gesetzlich Versicherten in Deutschland einen direkten, auf Rezept erstattungsfähigen Zugriff auf die App zu ermöglichen.

Metis Neurotec

Ebenfalls auf Diagnostik fokussiert ist Metis Neurotec aus Karlsruhe, eine Gründung von Dr. Simon Stock und Marius Gerdes, deren Ursprünge ins Jahr 2021 zurückgehen. Das Spin-off des Karlsruher Instituts für Technologie (KIT) entwickelt eine KI-basierte Software-Plattform zur Demenzprävention. Statt auf EEG-Scans setzen sie auf die intelligente Analyse von individuellen Risikofaktoren und Alltagsdaten, um personalisierte Präventions- und Interventionspläne gegen kognitiven Abbau zu erstellen. Gegenwärtig steht die Weiterentwicklung und Validierung der Plattform im Vordergrund, um künftig als fundiertes digitales Werkzeug die präventive Versorgungskette – auch im ländlichen Raum – nachhaltig zu unterstützen.

Nuuron