Aktuelle Events

Die Zukunft der digitalen Infrastruktur

Mit „DI 2020. IT-Infrastruktur für das digitale Zeitalter“ von TechData liegt eine Studie vor, die sich mit allen Trends befasst, die im Bereich Digitalisierung und IT-Infrastrukturen in Zukunft für Unternehmen wichtig werden. Viele sind es schon jetzt, ihre Bedeutung wird aber weiter wachsen. Um zukunftsfähig zu bleiben, müssen sich nicht nur etablierte Firmen rechtzeitig auf diese Trends einstellen.

Die Evolution der IT-Infrastruktur

Die digitale Transformation beschleunigt weiter und stellt Unternehmen damit vor immer größere Herausforderungen. Denn die IT-Anwendungen der Zukunft bringen neue Anforderungen mit sich, die mit den herkömmlichen Infrastrukturen nicht mehr bewältigen lassen.

Wer nicht nur reagieren, sondern proaktiv handeln möchte, muss daher bei grundlegenden Elementen ansetzen – das gilt vor allem für die Rechenzentren. Diese müssen immer leistungsfähiger werden, was vor allem der Forderung nach zunehmender Flexibilität geschuldet ist.

An ihnen lässt sich deutlich aufzeigen, wie sich die Anforderungen an die digitale Infrastruktur insgesamt geändert haben. Die Gründe hierfür liegen wiederum in den Veränderungen, die das digitale Arbeiten mit sich bringt. Zum Beispiel dessen weitere Verbreitung, die nur noch weniger als ein Viertel der Unternehmen ausklammert.

Mehr Geschwindigkeit, mehr Komplexität

Die grundlegenden Aspekte, um die sich eine funktionierende, zukunftsfähige digitale Infrastruktur dreht, lassen sich auf die einfache Formel herunterbrechen: mehr Geschwindigkeit und mehr Komplexität. Mehr Daten sollen so schnell wie möglich gesammelt, gespeichert, analysiert, visualisiert und weiterverarbeitet werden.

Traditionelle Workloads greifen in diesem Big-Data-Umfeld deshalb nicht mehr. Sie sind auf Standardprozesse ausgelegt, die ein hohes Maß an Stabilität (nicht zuletzt im Sinne der Ausfallsicherheit) bieten und kosteneffizient sind. Durch die fortschreitende Digitalisierung gewinnen neben diesen beiden aber weitere Faktoren an Bedeutung.

Flexiblere und agilere Anwendungen und Prozesse

Die Datenmengen erfordern durch ihr Ausmaß eine andere Herangehensweise. Zusammenhänge zu erkennen und wirtschaftlich sinnvolle Schlüsse zu ziehen, wird eine immer komplexere Aufgabe:

Rechenzentren müssen darauf eingestellt sein, denn sie ermöglichen wiederum innovative Strategien und Prozesse, um die gewonnenen Daten richtig nutzen zu können. Das schließt unter anderem die Arbeit mit verschiedenen Cloud-Architekturen ein.

Daneben müssen, in einem fortlaufenden Prozess, technologische Neuerungen berücksichtigt und gegebenenfalls in die bestehende Infrastruktur integriert werden. Nur so kann beispielsweise der notwendige Automationsgrad erreicht werden, um riesige Datenmengen verarbeiten zu können.

Schneller, komplexer, umfangreicher: Der Umgang mit verschiedenen Workloads

Moderne IT-Strukturen müssen letztlich einen schwierigen Balance-Akt schaffen:

Einerseits verlangt die digitale Transformation mehr Agilität in der Infrastruktur, um auf technologische Neuerungen, digitale Trends und Big-Data schnell genug reagieren zu können – das ist auch unter Wettbewerbsgesichtspunkten eine Notwendigkeit.

Andererseits gelten die „alten“ Prinzipien weiterhin, ihr Zusammenwirken mit neuen Komponenten wird allerdings komplexer. Agilität und Stabilität müssen in Einklang gebracht werden und das vor einem finanziellen Hintergrund, in dem Kosteneffizienz nach wie vor wichtig, Investitionen in die Ausgestaltung der Infrastruktur aber erforderlich sind.

Thema Sicherheit: Relevanter als jemals zuvor

Bei aller Anpassungs- und Leistungsfähigkeit bleibt das Thema Sicherheit ein überaus relevanter Punkt. Server-Systeme müssen unabhängig von der Unternehmensgröße technisch in der Lage sein, die Sicherheit von immer größeren Mengen sensibler Daten zu gewährleisten.

Das ist, auch dank Cloud-Technologie, nicht mehr so sehr eine Frage der Hardware, dafür umso mehr eine der Software. Diese auf dem neuesten technischen Stand zu halten ist deshalb eine der dringlichsten Aufgaben für moderne IT-Strukturen. Veraltete Server-Software kann zu gravierenden Sicherheitslücken führen.

Dass Server-Betriebssysteme altersbedingt nicht weiter supportet werden, sollte daher für die Verantwortlichen Anlass genug sein, schnell aktuelle Alternativen zu finden. Thomas-Krenn bietet als OEM Partner von Microsoft einen schnellen Umstieg für alle Unternehmen, die vom End of Support für Windows Server 2008/R2 und SBS 2011 betroffen sind.

Mit dem Microsoft Windows Server 2019 lassen sich nicht nur etwaige Sicherheitslücken schließen, die Server-Software lässt sich auch für individuelle Wünsche von KMU anpassen. Damit sind nicht nur etwaige Sicherheitsprobleme gelöst, sondern zugleich die Weichen gestellt für vielfältige Serverfunktionen.

Für datengetriebene Geschäftsmodelle ist eine leistungsfähige und skalierbare Infrastruktur unerlässlich. Voraussetzung für Lösungen, die den unterschiedlichen Anforderungen – Skalierbarkeit, Agilität und Innovation, Ausfallsicherheit, Automation, Kosteneffizienz, Sicherheit – an moderne IT-Strukturen gerecht werden kann, ist die Auseinandersetzung mit strategischen Trends der Digitalisierung.

Strategien für die Digitalisierung

Mit den IT-Infrastrukturen die Grundlagen schaffen, um die digitalen Strategien der Zukunft umsetzen zu können – das ist die Herausforderung, die Unternehmen in zunehmendem Maße bewältigen müssen. Diese strategischen Trends beeinflussen alle Unternehmensbereiche, von der Automatisierung von Arbeitsprozessen über die Geschäftsmodelle bis hin zur User Experience.

Agilität und Innovation

Digitale Infrastruktur muss nicht nur selbst agil und innovativ sein, um mit den Anforderungen des Digitalen Wandels Schritt halten zu können. Sie muss außerdem ausreichende Flexibilität in Sachen Organisation, Geschäftsmodelle und Unternehmensprozesse ermöglichen.

Anpassungsfähigkeit ist ein zentraler Erfolgsfaktor, da auch der Innovationsdruck auf die Unternehmen weiter steigt. Den IT-Plattformen und -Prozessen kommt dabei eine Schlüsselrolle zu. Dazu müssen die entsprechenden Systeme unterschiedlichste Anforderungen bewältigen und technologische Neuerungen integrieren können.

Der Großteil der Unternehmen (rund 85 Prozent) investiert deshalb laut TechData in diesem Bereich. Fast 40 Prozent der befragten Betriebe sehen sogar ein konstantes Wachstum über die nächsten Jahre vor – so die Studie von TechData. Damit schaffen sie die Grundlagen, um neue Technologien früher zu erkennen und für die eigenen Bedürfnisse adaptieren zu können.

Digital User Experience

Die Digitale Transformation hat die Schnittstellen zwischen Mensch und Maschine keineswegs obsolet gemacht, sie sind vielmehr wichtiger geworden. Vor allem in der Interaktion mit Kunden sind sie ein zentraler Aspekt. Diese Bedeutung hängt nicht zuletzt mit den vielen Kommunikationsmöglichkeiten zusammen, die zwischen Nutzern und Unternehmen bestehen.

Damit einher gehen unterschiedliche Erwartungen an die jeweiligen Kanäle, die dementsprechend unterschiedliche technische Lösungen umfassen können – und müssen. Eine solche Lösung sind beispielsweise Chatbots, die mit Künstlicher Intelligenz verschiedene Bereiche des Kundenservice übernehmen können, vom Support bis zur Kaufberatung.

Den Unternehmen scheint die Bedeutung dieser Schnittstellen für die digitalen Erfahrungen ihrer Kunden durchaus bewusst zu sein. Zumindest zeichnet sich bei den geplanten Investitionen in entsprechende Technologien ein ähnliches Bild wie im Bereich Agilität und Innovation – nur knapp über 8 Prozent gehen von geringeren Ausgaben aus. Dagegen sehen rund 41 Prozent ein konstantes Wachstum der Ressourcen für die Digital User Experience kommen.

Data Driven Business

Daten werden zunehmend wichtiger für zahlreiche Geschäftsmodelle. Die Handhabung immer größerer Datenströme und die Umwandlung in einen relevanten Nutzen sind entscheidende Werkzeuge im Wettbewerb, den die digitale Transformation nur noch mehr beschleunigt.

Dabei geht es längst nicht mehr darum, möglichst viele Daten zu sammeln. Big Data war im Grunde genommen nur der Anfang, die anfallenden Datenmengen sind nur die Grundlage für Entscheidungen und neue Entwicklungen in den Unternehmen.

Denn die Daten sind prinzipiell in jedem Konzern vorhanden: Kundendaten, Unternehmensdaten, Prozesse, Marktanalysen, Verkaufszahlen und andere. Sie alle werden ohnehin gesammelt, deswegen ist die wichtigste Frage, wie mit ihnen umzugehen ist, um daraus ein „reasonable product“ zu erschaffen.

Funktionieren kann das nur, wenn aus den Daten die richtigen Insights gefolgert und diese wiederum in konkrete Entscheidungen einfließen können. Die Daten sollen dabei helfen, interne Prozesse zu optimieren und zu automatisieren, was letztlich auch das Daten-Handling selbst betrifft. Im Idealfall besteht das Ergebnis in effizienteren Dienstleistungen und Produkten und somit in zufriedeneren Kunden.

Die Grundlagen hierfür zu schaffen, ist die eigentliche Herausforderung, welcher die Unternehmen mit mehr Investitionen begegnen wollen. Damit soll beispielsweise das Problem der Datenarchivierung und -sicherung angegangen werden. Darüber hinaus gilt es geeignete Methoden und Strategien zu finden, um Daten digital verfügbar und automatisiert analysierbar zu machen.

Im Data Driven Business laufen darum all jene Aspekte zusammen, die im Zusammenhang mit einer zukunftsfähigen IT-Struktur relevant sind: Technologische Voraussetzungen, flexible und agile Systeme, Möglichkeiten für Innovationen in allen Unternehmensbereichen, basierend auf den gewonnenen Daten.

Cognitive Company

Ein Schlüssel, um das Daten-Handling zu verbessern, ist Cognitive Computing. Dabei handelt es sich um Systeme, die Kontextelemente erkennen und verstehen können. Das ermöglicht es ihnen, strukturierte und unstrukturierte Daten zu verwenden und darin Bezüge zu finden.

Auf der Basis von Informationen und Prozessen können solche kognitiven Systeme selbständig und automatisiert an Problemlösungen arbeiten. Gleichzeitig entwickelt sich das System durch Machine Learning kontinuierlich weiter und verbessert seine eigenen Fähigkeiten. Dabei ist es deutlich breiter aufgestellt als KI-Systeme, die üblicherweise spezialisiert auf die Lösung für ein bestimmtes Problem sind.

In einer „Cognitive Company“ sollen kognitive Systeme durch ihre Lern- und Anpassungsfähigkeit Aufgaben übernehmen, für die bislang vornehmlich Menschen zuständig waren. Digitale Kommunikationsschnittstellen wie die bereits erwähnten Chatbots helfen, die gewonnenen Erkenntnisse wieder an menschliche Gesprächspartner zu vermitteln.

Vorläufig ist die Zahl der Unternehmen, die Cognitive Computing bereits anwenden, noch in einem überschaubaren Bereich. Anders sieht es bei der Implementierung von Künstlicher Intelligenz in die digitale Unternehmensstrategie aus – hier ist der Anteil mit 65 Prozent deutlich höher.

Internet of Things und Smart Products

Die Möglichkeiten digitaler Infrastrukturen betreffen aber selbstverständlich nicht nur jene Prozesse, die sich um das Sammeln, Verwalten, Analysieren und Nutzbarmachen von Daten drehen. Über die Wertschöpfungskette hinaus lassen sich außerdem Logistik und Produktion verbessern.

Die Infrastruktur bildet, zusammen mit modernen Sensoren, die Grundlage für ein umfassendes Internet of Things, in dem vernetzte Maschinen miteinander interagieren können. Die Umsetzung von Industrie 4.0-Konzepten ist unter anderem wegen der Möglichkeiten für innerbetriebliche Optimierungen weit verbreitet, der Fortschritt dabei ist laut TechData jedoch recht unterschiedlich.

Da vor allem in produzierenden Betrieben die Potenziale – Stichwort Automatisierung – sehr groß sind, besteht ein großes Interesse daran, Lösungen für die eigenen Bedürfnisse zu entwickeln.

Automatisierung

In digitalen Systemen spielt die Automatisierung auf verschiedenen Ebenen eine wichtige Rolle. Beziehungsweise eröffnet die Digitalisierung neue Möglichkeiten für automatisiert ablaufende Unternehmensprozesse. Als prominentestes Beispiel fallen dazu smarte Fabriken ein, in der die Produktion weitgehend oder sogar vollständig digital und automatisiert abläuft. Überwiegend betrifft das repetitive Arbeitsabläufe ohne große Veränderungen.

Dank flexibler digitaler Infrastrukturen und Cloud Computing können diese Prozesse aber ebenfalls deutlich flexibler gestaltet werden. Das ist etwa für personalisierte und individualisierte Produkte ein großer Vorteil, denn diese können ohne größeren Mehraufwand realisiert werden.

Die Produktion wird dadurch kosteneffizient, wie sie überhaupt insgesamt effizienter wird: Ressourcen können besser verplant werden, von den zu verarbeitenden Materialien bis hin zum notwendigen Energieeinsatz.

Grundsätzlich ist das genauso in kleineren mittelständischen Unternehmen möglich, auch wenn die Herangehensweisen bei der Digitalisierung sich von denen der Global Player unterscheiden. Denn gerade in diesen Betrieben fallen die Investitionen in eine langfristige Verbesserung von IT-Infrastruktur und Automatisierung häufig am schwersten.

Trends für die IT-Infrastruktur der Zukunft

Big Data verspricht zahllose unternehmerische Möglichkeiten. Voraussetzung ist allerdings, die wachsenden Datenmengen sinnvoll nutzen und sicher aufbewahren zu können. Dazu braucht es sowohl technische Lösungen als auch neue Konzepte, damit die IT-Infrastruktur bei der Bewältigung der Daten helfen kann.

Auf diese Weise können Unternehmen ganz neue Vorteile für ihre Wertschöpfungskette ziehen, beispielsweise durch neue Geschäftsmodelle. Grundvoraussetzung für alle sich abzeichnenden Trends bleibt aber ein leistungsstarkes Rechenzentrum.

Infrastructure-as-a-Service (IaaS) und Platform-as-a-Service (Paas)

Daneben ist es vor allem das Cloud Computing, das Unternehmen in Sachen Digitalisierung zahlreiche Möglichkeiten eröffnet. Denn es geht hier schon lange nicht mehr nur um einen praktischen Weg, Daten zu archivieren, ohne eigene Speicherkapazitäten zu belasten.

Vor allem Start-ups können über die Cloud eine Vielzahl an Diensten beziehen, für die sie dann keine eigenen IT-Ressourcen aufbringen müssen. Telefonie, Mail, Meetings und andere Aspekte des Arbeitsalltags lassen sich beispielsweise per Cloud-Service nutzen, denkbar sind aber noch viel weitreichendere Cloud-Anwendungen. Infrastructure‑as‑a‑Service (IaaS) etwa stellt Ressourcen rund um die IT‑Infrastruktur bereit. Das umfasst Rechenleistung genauso wie Netzwerkkapazitäten.

Auf diesem Wege kann das unternehmenseigene Rechenzentrum erheblich entlastet werden, da es die digitale Infrastruktur nicht mehr alleine tragen muss – selbst Infrastrukturen ohne eigenen physischen Server sind realisierbar. Damit entfallen nicht zuletzt die Kosten für Anschaffung und Wartung der ansonsten notwendigen Hardware.

Platform-as-a-service (PaaS) schafft die Arbeitsumgebung im engeren Sinne. Dazu gehören beispielsweise Betriebssysteme, Datenbanken und Anwendungen.

Der große Vorteil besteht unter anderem darin, dass die bereitgestellten Applikationen immer in der aktuellsten Version vorliegen. Die Entwicklung übernimmt dabei der Cloud-Provider, das Unternehmen selbst spart dadurch Zeit und Geld. Da sich die Anwendungen außerdem in ihrem Umfang ganz an die individuellen Bedürfnisse der Nutzer anpassen lassen, können auch damit freigewordene Ressourcen an anderer Stelle eingesetzt werden.

Beide Ansätze bedeuten in ihren jeweiligen Bereichen Einsparungspotenziale für die Unternehmen, da wichtige und arbeitsintensive Aufgabenbereiche ausgelagert werden können. Die virtuelle Infrastruktur bietet außerdem ein hohes Maß an Flexibilität für die Ausgestaltung und die Ressourceneinteilung.

Sowohl IaaS als auch PaaS können IT-Infrastrukturen in Unternehmen verschiedenste Möglichkeiten bieten, um die gewünschten Leistungsanforderungen – stabil, sicher, flexibel, agil, schnell – zu erreichen. Das gilt für unterschiedliche Anwendungsgebiete, von der Datenanalyse über E-Commerce, Digital Marketing und CRM bis hin zu IoT-Lösungen und Content Management für Online-Portale.

Eine vollständige Umstellung auf Cloud-Services ist dabei gar nicht zwingend notwendig. Stattdessen können Unternehmen sich über die für sie interessantesten Anwendungsmöglichkeiten an die Thematik herantasten.

In Zukunft wird der Umgang mit Cloud-Lösungen aber mit großer Wahrscheinlichkeit auf breiterer Ebene stattfinden. Obwohl Cloud Computing nicht ganz ohne Nachteile ist und gerade bei den Themen Datenschutz und Performanceabhängigkeit von der Internetverbindung kritisch betrachtet werden muss.

Hybrid Cloud und hyperkonvergente Infrastrukturen

Cloud-Konzepte sind zwar einer der bestimmenden Trends bei der Entwicklung moderner digitaler Infrastrukturen, aber längst nicht die einzigen. Dass verschiedene Cloud-Modelle in Hybrid Clouds aufgehen, unterstreicht aber nochmals den Stellenwert dieser Technologie.

Die Idee hinter hybriden Cloud-Lösungen besteht darin, möglichst viele Vorteile zu erhalten, ohne gleichzeitig die Nachteile in Kauf nehmen zu müssen:

- Public Clouds bieten die oben beschriebene Flexibilität, wie sie in IaaS- und PaaS-Ansätzen zum Tragen kommt.

- Private Clouds hingegen versprechen das Maß an Datensicherheit, die in einer Public Cloud nicht unbedingt gewährleistet werden können.

- Kombiniert werden beide Modelle mit traditioneller Infrastruktur. Diese bindet zwar mehr Ressourcen als eine reine Cloud-Lösung, auf der anderen Seite bleiben Unternehmen so unabhängiger von den Providern.

Insgesamt wird die Infrastruktur dadurch komplexer, vor allem beim Verwaltungsaufwand. Das wirkt sich unter Umständen auf die Effizienz der Arbeitsprozesse und Sicherheitsbelange aus, die eigentlich auf diesem Weg umgangen werden sollten.

Deshalb werden beispielsweise hyperkonvergente Infrastrukturen (Hyper Converged Infrastructures) zunehmend zu einer Alternative. Diese versprechen eine weitreichende Vereinfachung der Infrastruktur, bei der Rechenleistung, Speicher und Netzwerk als virtuelle Ressourcen bereitgestellt und von einer einzigen Management-Lösung verwaltet werden.

Die IT-Infrastruktur wird damit vollständig virtualisiert und unabhängig von der Hardware. Waren derartige Lösungen bis vor einigen Jahren noch aufwändig und teuer – eigene Server-Architekturen und weitere Elemente erforderten hohe Investitionen und den Einsatz von Spezialisten – werden HCI‑Lösungen inzwischen als Plug & Play-Modell angeboten.

Neue Speichertechnologien

Eine Herausforderung für sämtliche digitalen Infrastrukturen bleibt das Speichern von großen, unstrukturierten Datenmengen. Neben den lange Zeit üblichen Methoden Block Storage und File Storage hat sich in den vergangenen Jahren die Objektspeicherung als Möglichkeit für diese Aufgabe etabliert.

Insofern ist Object Storage keine gänzlich neue Technologie, sie hat aber enorm an Bedeutung gewonnen. Denn die Beschreibung von Daten als Objekte – unter anderem mit Hilfe der Meta-Daten – vereinfacht die Speicherung, gerade bei großen Datenmengen. Dienste wie Dropbox oder Google Docs haben das vorgemacht.

Unkomplizierter lässt sich prinzipiell auch der Zugriff auf die einzelnen Objekte in einer Cloud-Umgebung gestalten. Da dieser über das Internet geschieht, können mehrere Nutzer gleichzeitig auf die Objekte zugreifen. Dazu ist Object Storage bestens geeignet für das Erstellen von Backups und die Archivierung von Daten. Gegenüber anderen Speichertechnologien und NAS‑Infrastrukturen ist diese Methode daher im Vorteil.

Auch physisch entwickeln sich die Speichermedien weiter, die wichtigste Technologie in dieser Hinsicht sind Flash-Speicher. Diese versprechen deutlich schnellere Verarbeitungsgeschwindigkeiten im Vergleich zu magnetischen Festplatten.

Das macht Flash Storage zu einer attraktiven Alternative in vielen Anwendungsgebieten. Etwa dort, wo es um die Verarbeitung von vielen Daten geht, die möglichst in Echtzeit ablaufen soll – von der Datenanalyse bis zum Maschinenlernen bieten sich Unternehmen zahlreiche Einsatzmöglichkeiten für All-Flash-Arrays.

Digitale Infrastrukturen als Herausforderungen

Für Unternehmen, unabhängig von ihrer Größe, bestehen also weiterhin viele Handlungsfelder in Bezug auf den Aufbau zukunftsfähiger digitaler Infrastrukturen. Im Kern müssen überall wachsende Datenmengen gemanagt und die Voraussetzungen dafür geschaffen werden. Die verschiedenen digitalen und technologischen Trends eröffnen individuelle Möglichkeiten, um sich gemäß den speziellen Anforderungen im eigenen Unternehmen passgenau aufzustellen.

Dabei ist es nicht mehr zwingend notwendig, die IT grundsätzlich alleine aufzubauen. Die meisten Dienste lassen sich auslagern. Das geht zwar zu Lasten der Unabhängigkeit, reduziert aber beispielsweise gleichzeitig Investitionen in Hard- und Software.

Unerlässlich ist jedoch die Auseinandersetzung mit einer möglichen digitalen Strategie, die einerseits den Bedarf erfasst und andererseits langfristige Ziele definiert. Aufbauen darauf lässt sich eine digitale Infrastruktur errichten, die bestmöglich zum Unternehmen passt und diesem ausreichend Flexibilität lässt, um neue Trends und Entwicklungen schnell integrieren zu können.

Diese Artikel könnten Sie auch interessieren:

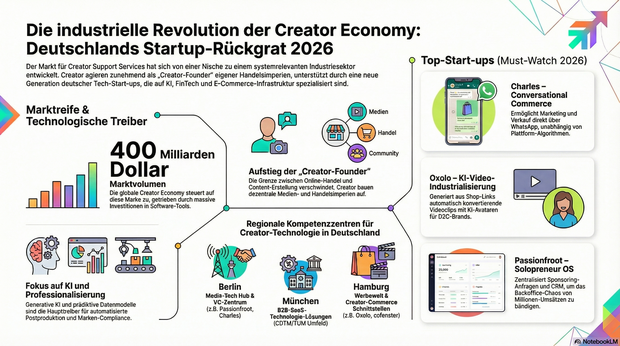

Von Streaming bis Gaming – Diese Branchen profitieren vom digitalen Nutzerverhalten

Wie On-Demand-Modelle Branchen prägen und welche Erfolgsfaktoren Gründer jetzt kennen müssen.

Inhalte, Dienstleistungen und Unterhaltung werden zunehmend flexibel, mobil und individuell konsumiert. Während früher feste Zeiten und physische Angebote dominierten, stehen heute On-Demand-Modelle im Mittelpunkt. Diese Entwicklung wirkt sich nicht nur auf einzelne Produkte aus, sondern prägt ganze Branchen und schafft neue wirtschaftliche Dynamiken. Insbesondere digitale Geschäftsmodelle profitieren von der steigenden Erwartung an Verfügbarkeit, Geschwindigkeit und Personalisierung.

Digitales Nutzerverhalten im Wandel

Die Verschiebung der Nutzungsgewohnheiten von stationären Desktop-Lösungen hin zu mobilen Endgeräten ist der stärkste Treiber der aktuellen Digitalökonomie. On-Demand ist zum Standard geworden: Ob Content, Services oder Unterhaltung – die Erwartungshaltung der Konsumenten ist geprägt von sofortiger Verfügbarkeit und einer hohen Passgenauigkeit durch Personalisierung.

- Inhalte jederzeit abrufbar: Die zeitliche Entkopplung von linearen Sendeplänen oder Öffnungszeiten.

- Omnichannel-Nutzung: Ein nahtloser Übergang zwischen Smartphone, Tablet, Smart-TV und Laptop.

- Komfort als Zahlungsargument: Eine wachsende Bereitschaft, für Zeitersparnis und einfache Bedienbarkeit Abonnements abzuschließen.

Streaming als Vorreiter der digitalen Transformation

Streaming-Dienste gelten als eines der prägendsten Beispiele für die Anpassung an modernes Nutzerverhalten. Klassische Medienformate wurden durch Plattformen ersetzt, die Inhalte jederzeit zugänglich machen. Gleichzeitig haben sich abonnementbasierte Modelle etabliert, die stabile und planbare Einnahmen ermöglichen.

Ein zentraler Erfolgsfaktor liegt in der Nutzung von Daten. Algorithmen analysieren das Verhalten der Nutzer und liefern personalisierte Empfehlungen, wodurch die Verweildauer und Kundenbindung gesteigert werden. Für Unternehmen ergibt sich daraus ein skalierbares Modell, das sich international ausrollen lässt und kontinuierlich optimiert werden kann. Die Grenzkosten pro neuem Nutzer sind minimal. Eine starke Kundenbindung erfolgt hier primär durch exklusiven Content und ein personalisiertes Interface.

In diesem Bereich steht allerdings eine Wende bevor. Durch die große Akzeptanz und Nachfrage sind zahlreiche Angebote und dadurch ein fragmentierter Markt entstanden. Mehrere Abos pro Haushalt sind die Regel und Nutzer wünschen sich zunehmend eine Bündelung.

Gaming und interaktive Unterhaltung auf dem Vormarsch

Gaming hat sich von einer Nische zu einem der weltweit größten digitalen Märkte entwickelt und übertrifft in den Umsätzen längst die Film- und Musikindustrie zusammen. Besonders entscheidend ist hier der soziale Aspekt: Community-Building innerhalb der Spielewelten macht Gaming zu einem sozialen Netzwerk. Der Übergang zu Live-Events und Multiplayer-Erlebnissen schafft eine emotionale Bindung, die weit über das reine Konsumieren hinausgeht.

Gleichzeitig verschiebt sich der Fokus von einmaligen Käufen hin zu kontinuierlichen Einnahmequellen, etwa durch In-Game-Käufe oder abonnementbasierte Modelle. Diese Entwicklung zeigt, wie stark Nutzererlebnisse und soziale Komponenten den Erfolg digitaler Angebote beeinflussen.

iGaming als Teil der digitalen Entertainment-Ökonomie

Innerhalb der digitalen Unterhaltungslandschaft nimmt auch der iGaming-Bereich eine besondere Rolle ein. Dieser Sektor profitiert in ähnlicher Weise von technologischen Entwicklungen wie Streaming und Gaming, insbesondere durch mobile Nutzung, intuitive Benutzeroberflächen und schnelle Transaktionsmöglichkeiten.

Die Plattformen sind darauf ausgelegt, ein möglichst reibungsloses und immersives Nutzererlebnis zu bieten. Online Casino Schweiz präsentiert eine klare Strukturierung unterschiedlicher Games sortiert nach Themen oder Anbietern. Above the fold finden Nutzer Infos zu aktuellen Top-Gewinnern, Verlosungs-Aktionen oder neuen Titeln. Die Kombination aus Gamification-Elementen, internationaler Skalierbarkeit und datenbasierter Optimierung macht diesen Markt aus wirtschaftlicher Perspektive besonders interessant.

Typische Merkmale dieser Branche sind:

- hohe Nutzerbindung durch spielerische Elemente

- globale Ausrichtung digitaler Plattformen

- kontinuierliche Anpassung durch Nutzerdaten

Wirtschaftlichkeit und Transferpotenzial

Die Branche zeichnet sich durch überdurchschnittlich hohe operative Margen aus, da nach der initialen Entwicklung der Plattform und der Integration von Content die Skalierungskosten gering bleiben. Während Marketing- und Lizenzkosten substanziell sind, ermöglichen automatisierte Prozesse in der Kundenverwaltung und Zahlungsabwicklung eine hohe Profitabilität.

Diese Effizienz lässt sich auf andere digitale Angebote übertragen: Das Prinzip der Mikro-Interaktionen und die sofortige Belohnung (Instant Gratification) sind Mechanismen, die auch im E-Commerce oder in Produktivitäts-Apps die Conversion-Rate steigern. Wer lernt, die im iGaming perfektionierten Methoden der Datenanalyse und Echtzeit-Personalisierung zu nutzen, kann die Kundenbindung in nahezu jedem digitalen Geschäftsmodell signifikant erhöhen.

Was Gründer daraus lernen können

Die Analyse erfolgreicher digitaler Branchen zeigt klare Muster. Im Mittelpunkt steht nicht die Technologie selbst, sondern deren Anwendung im Kontext realer Nutzerbedürfnisse. Plattformdenken, Datenanalyse und eine konsequente Ausrichtung auf Benutzerfreundlichkeit sind zentrale Erfolgsfaktoren.

Konkrete Impulse:

- Verhalten statt Produkt: Geschäftsmodelle sollten dort ansetzen, wo Nutzer bereits Zeit verbringen oder Reibungsverluste erleben.

- Iteration: Schnelles Testing von Funktionen (MVP-Ansatz) ermöglicht es, am Puls der Zielgruppe zu bleiben.

- Mobile-First-Denkweise: Jede Lösung muss primär auf dem kleinsten Bildschirm perfekt funktionieren.

- Entwicklung skalierbarer Plattformlösungen

Das digitale Nutzerverhalten entwickelt sich dynamisch weiter und beeinflusst zahlreiche Branchen nachhaltig. Unternehmen, die diese Veränderungen frühzeitig erkennen und in ihre Strategien integrieren, sichern sich entscheidende Wettbewerbsvorteile. Besonders erfolgreich sind Modelle, die Flexibilität, Personalisierung, einfache Zugänglichkeit und die Einbindung in starke App-Ökosysteme miteinander verbinden. In einer zunehmend digitalen Wirtschaft entstehen neue Chancen vor allem dort, wo technologische Möglichkeiten auf veränderte Erwartungen treffen.

Weitere Gewinner des Nutzerwandels

Neben Unterhaltung und Gaming profitieren auch andere Branchen vom veränderten Verhalten. Besonders deutlich wird dies in Bereichen, die auf flexible Nutzung und personalisierte Angebote setzen.

Dazu zählen unter anderem:

- E-Learning-Plattformen, die ortsunabhängiges Lernen ermöglichen

- Fitness- und Gesundheits-Apps, die individuelle Trainingspläne bieten

- Fintech-Lösungen, die schnelle und unkomplizierte Zahlungsprozesse unterstützen

Gemeinsam ist diesen Geschäftsmodellen eine starke Nutzerzentrierung. Sie bieten Lösungen, die sich nahtlos in den Alltag integrieren lassen und dabei individuelle Bedürfnisse berücksichtigen.

Was Gründer daraus lernen können

Der entscheidende Erfolgsfaktor in der digitalen Ökonomie ist die radikale Nutzerzentrierung. Erfolgreiche Unternehmen denken nicht mehr in isolierten Produkten, sondern in Plattformen, die ein Problem ganzheitlich lösen. Die Bedeutung von Datenanalyse zur stetigen Verbesserung der UX kann dabei nicht überschätzt werden.

Die Verfestigung digitaler Gewohnheiten ist ein unumkehrbarer Prozess. Neue Märkte werden dort entstehen, wo technologische Möglichkeiten auf neue menschliche Bedürfnisse treffen. Die größten Chancen liegen für Gründer und etablierte Unternehmen dort, wo sich das Nutzerverhalten schneller wandelt als die bestehenden, oft noch trägen Angebote am Markt.

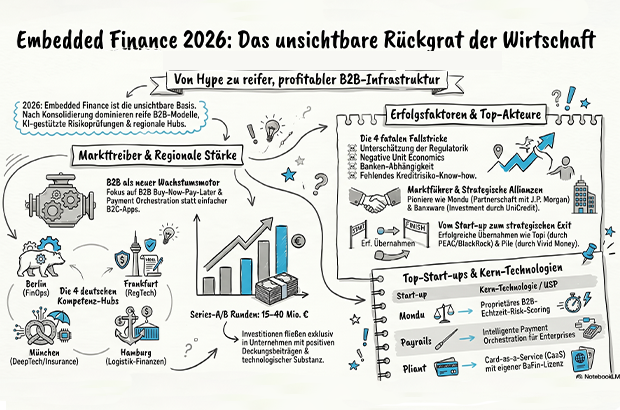

Embedded-Finance-Start-up-Report 2026

Der unsichtbare Bankensektor: Wie Embedded Finance und die dazugehörigen Start-ups die Wirtschaft des Jahres 2026 prägen.

Einst war es das große Versprechen für eine Handvoll hipper Neobanken, heute ist es das unsichtbare Rückgrat der europäischen Wirtschaft: Embedded Finance. Im Jahr 2026 wird das Marktwachstum längst nicht mehr von der fixen Idee isolierter Bank-Apps dominiert, denn jedes zukunftsorientierte Unternehmen ist mittlerweile selbst zu einem/einer Finanzdienstleister*in geworden. Ob Software-as-a-Service-Anbieter*in, Logistik-Plattform oder Marktplatz – die nahtlose Integration von Zahlungen, Krediten und Versicherungen in nicht-finanzielle Kund*innenreisen ist das neue Paradigma.

Dieser Report beleuchtet eine Branche, die den „Sturm der Konsolidierung“ überlebt hat und nun mit reifen Geschäftsmodellen und echten Profiten die Architektur der modernen Wirtschaft neu programmiert.

Vom Hype zur fundamentalen Reife

Nach den massiven Zinsanpassungen und regulatorischen Aufräumarbeiten der Jahre 2023 und 2024 zeichnet der Embedded-Finance-Markt heute ein Bild robuster Reife. Renommierte Analystenhäuser wie Bain & Company und Dealroom haben diese Entwicklung früh vorgezeichnet: Der globale Markt für Embedded-Finance-Dienstleistungen hat sich in ein Multimilliarden-Segment verwandelt, dessen europäisches Transaktionsvolumen mittlerweile signifikante Teile des digitalen B2B- und B2C-Handels stützt. Der technologische Haupttreiber dieser neuen Ära ist unbestreitbar die künstliche Intelligenz, genauer gesagt proprietäre Machine-Learning-Modelle, die Risikobewertungen in Millisekunden durchführen und Transaktionsströme dynamisch optimieren. Investor*innen honorieren diese technologische Tiefe: Wir sehen heute höchst realistische Series-A- und Series-B-Runden im Bereich von 15 bis 40 Millionen Euro für Start-ups, die nachweislich positive Deckungsbeiträge aufweisen. Es fließt wieder signifikant Kapital, doch es fließt exklusiv in Substanz und Skalierbarkeit, nicht mehr in reines Marketing.

Die neuen Treiber: B2B, Vertikalisierung und Orchestrierung

Wenn man über das Offensichtliche wie einfache White-Label-Kreditkarten hinausblickt, dominieren im Jahr 2026 drei spezifische Sub-Sektoren den Markt. Allen voran steht B2B Buy-Now-Pay-Later, eine Disziplin, die das traditionelle, schwerfällige Factoring abgelöst hat und nun direkt in B2B-Checkouts und Beschaffungsnetzwerke integriert ist. Ein weiterer massiver Treiber ist die sogenannte Payment Orchestration für vertikale SaaS-Lösungen. Hier werden komplexe, branchenspezifische Zahlungsflüsse – etwa im Handwerk oder in der Gastronomie – automatisiert im Hintergrund abgewickelt. Zuletzt etabliert sich Embedded Insurance zunehmend im Industriekontext, wo Maschinen nicht mehr nur geleast, sondern im selben Atemzug transaktionsbasiert versichert werden. Pioniere wie die Berliner Mondu oder auch europäische Schwergewichte wie Swan haben den Weg für diese hochspezialisierten Infrastruktur-Layer geebnet und gezeigt, wie tiefgreifend diese Geschäftsmodelle in die Wertschöpfungsketten der Realwirtschaft eingreifen.

Die Lektionen der BaaS-Krise

Doch dieser Reifegrad wurde teuer erkauft. Der Beinahe-Kollaps des britischen Banking-as-a-Service-Pioniers Railsr und die drastischen BaFin-Sonderprüfungen samt Wachstumsbeschränkungen bei etablierten deutschen Playern wie Solaris in den Jahren zuvor haben den Markt fundamental erschüttert. Der Traum, Finanzdienstleistungen wie einfache Legosteine zusammenzustecken, kollidierte brutal mit der harten Realität des Bankwesens.

Aus diesen gescheiterten Hoffnungen lassen sich für heutige Gründer*innen vier konkrete, fatale Fallstricke ableiten. Der erste und wichtigste ist die eklatante Unterschätzung der Regulatorik; Compliance lässt sich nicht auslagern, und Aufsichtsbehörden dulden keine agilen Versuch-und-Irrtum-Prozesse bei der Geldwäscheprävention. Der zweite Fallstrick ist die Falle der negativen Unit Economics im B2C-Sektor, wo exorbitante Kund*innenakquisitionskosten oft nur durch kontinuierliches VC-Geld gedeckt wurden. Drittens das Klumpenrisiko der Abhängigkeit von einer einzigen Partnerbank, deren Ausfall das eigene Start-up über Nacht handlungsunfähig macht. Und viertens die Fehlannahme, dass Technologie allein ausreicht; wer heute kein tiefes Verständnis für klassisches Bilanzstruktur- und Kreditrisikomanagement mitbringt, scheitert unweigerlich.

Das deutsche Netzwerk: Die Schmieden der Infrastruktur

Deutschland hat sich in dieser Konsolidierungsphase als einer der resilientesten Standorte in Europa bewiesen, getragen von vier essenziellen Hubs. Berlin verteidigt dabei seinen Status als unangefochtene Hauptstadt für FinOps und B2B-Zahlungsinfrastruktur, massiv befeuert durch die Talent-Pipelines der TU Berlin sowie das dichte Netzwerk an Serial Entrepreneurs aus der N26- und SumUp-Schule. Frankfurt am Main bildet den unverzichtbaren regulatorischen Gegenpol; hier, im Schatten von EZB und BaFin, entstehen im Umfeld des TechQuartiers und der Frankfurt School of Finance and Management jene Start-ups, die komplexe Compliance- und Treasury-Architekturen für Großbanken bauen. München dominiert den Bereich DeepTech und Embedded Insurance im industriellen B2B-Kontext, was auf die herausragende Stellung des Center for Digital Technology and Management (CDTM) und die enge Verzahnung mit der ansässigen Versicherungs- und Automobilindustrie zurückzuführen ist. Hamburg schließlich hat sich als europäischer Hotspot für Trade Finance und in Logistikketten eingebettete Finanzierungen etabliert, gestützt durch die traditionelle Stärke der Hansestadt im globalen Handel.

Investor*innen-Radar

Das Ökosystem der Geldgeber*innen hat sich im Jahr 2026 stark differenziert und professionalisiert. An der Spitze der spezialisierten VCs agieren Fonds wie FinTech Collective und Motive Ventures (hervorgegangen aus der Übernahme des Berliner VCs embedded/capital), die mit tiefem technologischen Verständnis gezielt in Infrastruktur-Layer investieren. Unter den Top-Tier Generalisten ragen Cherry Ventures, Earlybird und Point Nine heraus, die insbesondere Series-A-Runden bei überzeugenden B2B-SaaS-Modellen anführen.

Ein starker Motor sind zudem Corporate VCs und bankennahe Fonds geworden: CommerzVentures, als unabhängiger Player, treibt Themen wie Climate-Fintech massiv voran, während CVCs der Realwirtschaft wie Allianz X und Porsche Ventures strategisch in Start-ups investieren, die sich nahtlos in ihre eigenen vertikalen Ökosysteme einklinken lassen. In der kritischen Frühphase wird der Markt von einer hochgradig vernetzten Gruppe aus Business Angels angetrieben, die nicht nur erstes Kapital, sondern vor allem regulatorisches Know-how und entscheidende Bankennetzwerke einbringen

Die Top Start-ups (Must-Watch)

Für die nachfolgende Liste der Must-Watch-Unternehmen haben wir strikte Kriterien angelegt. Die Auswahl basiert auf nachgewiesener Marktrelevanz durch echte Kund*innenimplementierungen, einem hohen technologischen Reifegrad und einem diversifizierten Ansatz bei der Lösung komplexer Finanzinfrastrukturprobleme. Zudem war ein nachhaltiges Investoren-Vertrauen in den letzten zwölf Monaten ein Schlüsselfaktor. Wir beleuchten hierbei ausschließlich Start-ups mit Hauptsitz in Deutschland, deren Gründung im Jahr 2020 oder später erfolgte, um die wahre nächste Generation der Branche abzubilden.

Banxware

Das 2020 von Miriam Wohlfarth und Jens Röhrborn gegründete Banxware hat sich als Marktführer für Embedded Lending in Deutschland etabliert. Banxware bietet eine White-Label-Lösung, mit der Marktplätze und Zahlungsdienstleister*innen ihren Händler*innen Sofortkredite basierend auf historischen Umsatzdaten anbieten können. Der USP liegt in der extrem schnellen Risikoprüfung und der nahtlosen API-Integration in bestehende Plattformen. Das enorme Vertrauen der Finanzbranche in dieses Modell spiegelt sich massiv auf Investor*innenseite wider: Neben frühen Leadern wie Element Ventures (heute 13books Capital) ist insbesondere der Einstieg der Großbank UniCredit ein Ritterschlag. Die Bank führte nicht nur die Series-A-Runde an, sondern legte Mitte 2025 mit einem weiteren strategischen Millionen-Investment nach, um die europäische Expansion von Banxware gemeinsam voranzutreiben.

Pliant

Im Jahr 2020 von Malte Rau und Fabian Terner aus der Taufe gehoben, definiert Pliant den Markt für B2B-Kreditkarten und Ausgabenmanagement neu. Das B2B-SaaS-Modell kombiniert eine moderne Karteninfrastruktur mit einer tiefen API-basierten Integration in Buchhaltungs- und ERP-Systeme. Der technologische Vorsprung liegt im eigenen Card-as-a-Service-Angebot (CaaS), das anderen B2B-Plattformen den Launch eigener Kreditkartenprogramme ermöglicht. Ein entscheidender Meilenstein war hierfür der Erhalt der eigenen E-Geld-Lizenz der BaFin, die Pliant die nötige regulatorische Unabhängigkeit verleiht. Unterstützt wird Pliant von namhaften Investoren wie SBI Investment, Alstin Capital – und einem Investment des globalen Schwergewichts PayPal Ventures, das das enorme Skalierungspotenzial der Plattform bestätigt.

Mondu

Die Serial Entrepreneurs Malte Huffmann, Philipp Povel und Gil Danziger gründeten Mondu 2021 und revolutionieren damit den B2B-Zahlungsverkehr. Ihr B2B-BNPL-Modell ermöglicht es Geschäftskund*innen, online wie B2C-Kund*innen auf Rechnung oder in Raten zu kaufen, während der Händler sofort sein Geld erhält. Die Kerntechnologie ist ein proprietäres Echtzeit-Risk-Scoring für Firmenkund*innen. Finanziert wurde diese Vision anfangs von Top-Tier-Fonds wie Valar Ventures und Cherry Ventures. Der ultimative Ritterschlag erfolgte jedoch Ende 2025: Neben dem Erhalt der E-Geld-Lizenz sicherte sich Mondu eine 100-Millionen-Euro-Fazilität von J.P. Morgan Payments inklusive einer strategischen Partnerschaft, um die Buy-Now-Pay-Later-Lösung dem europäischen Kund*innen stamm der US-Großbank anzubieten.

Payrails

Gegründet 2021 von Orkhan Abdullayev, Emre Talay und Nicolas Thouzeau, löst Payrails die Herausforderung der Payment Orchestration. Das FinOps-Start-up baut ein intelligentes Betriebssystem für Zahlungen, das Transaktionen für Enterprise-Kund*innen dynamisch über verschiedene Provider routet, um Kosten zu senken und Autorisierungsraten zu maximieren. Die technologische Brillanz dieser Architektur lockte früh Schwergewichte wie Andreessen Horowitz und EQT Ventures an. Im Sommer 2025 zündete Payrails die nächste Stufe: HV Capital führte eine massive Series-A-Runde über 32 Millionen US-Dollar an, bei der auch alle Top-Tier-Altinvestoren erneut mitzogen, um die globale Expansion der Plattform endgültig zu sichern.

Finmid

Die beiden N26-Alumni Max Schertel und Alexander Talkanitsa starteten Finmid 2021 mit der Mission, jede B2B-Plattform zu einer Finanzierungsquelle zu machen. Ihr Geschäftsmodell fokussiert sich auf Embedded B2B Lending, das speziell auf die Anforderungen von Marktplätzen (wie etwa dem Partner Wolt) zugeschnitten ist – ohne dass diese Plattformen eigenes Kapital bereitstellen oder Risiken tragen müssen. Ihr USP ist die radikale Simplifizierung der B2B-Kreditvergabe durch smarte Echtzeit-Datenverknüpfungen. Angetrieben von einer wuchtigen 23-Millionen-Euro-Series-A-Runde, angeführt vom britischen Fonds Blossom Capital und dem Seed-Lead Earlybird, treibt das Start-up seine aggressive europäische Expansion unaufhaltsam voran.

Topi (Exit)

Charlotte Pallua und Estelle Merle brachten Topi 2021 an den Start, um das Hardware-as-a-Service-Modell in den B2B-Bereich zu integrieren. Über die Plattform können B2B-Kund*innen IT-Equipment flexibel mieten, wobei Topi den gesamten Prozess vom Checkout über das Refinancing bis zum Asset-Management abwickelt. Nachdem Topi mit Händler*innen wie Cyberport massiv skalierte und von Top-VCs wie Index Ventures und Creandum finanziert wurde, erfolgte im Sommer 2025 der strategische Exit: Das FinTech wurde von dem internationalen Leasing-Giganten PEAC Solutions (einem BlackRock-Portfoliounternehmen) übernommen, um das innovative B2B-Mietmodell global in dessen gewaltige Finanzierungsinfrastruktur einzugliedern.

Hakuna

Im Bereich Embedded Insurance schlägt das 2021 von Sebastian Jost, Rupert Mayer und Orhan Köroglu gegründete Hakuna neue Wege ein. Das Start-up bietet Händler*innen eine Plattform für Garantieverlängerungen und Produktschutzversicherungen, nahtlos integriert in den Online- und Offline-Checkout. Der USP ist ein völlig neu gedachtes, digitales Schadensmanagement, das die Abwicklung für Endkund*innen radikal vereinfacht. Finanziert von Top-VCs wie Earlybird und Visionaries Club, hat Hakuna mittlerweile den Sprung ins absolute Enterprise-Segment geschafft: Im Jahr 2025 integrierten Branchenriesen wie Vorwerk, STIHL und Mister Spex die Embedded-Technologie des Start-ups, um ihre eigenen, maßgeschneiderten Produktschutzprogramme europaweit zu skalieren.

Pile (Exit)

Jessica Holzbach startete Pile 2022 und pivotierte das Modell nach dem Krypto-Winter erfolgreich zu einem hochspezialisierten Treasury-Angebot für Start-ups. Die B2B-SaaS-Technologie bündelte Konten und automatisierte die Diversifikation von Einlagen zur Risikominimierung. Das Modell erregte schnell Aufmerksamkeit und führte bereits im Sommer 2024 zu einem frühen Exit: Die 2019 gegründete Berliner Neobank Vivid Money übernahm das Start-up, um das eigene Business-Banking-Angebot mit Piles Treasury-Technologie aufzurüsten – ein Paradebeispiel für die rasante Konsolidierung im FinTech-Infrastrukturmarkt.

Internationaler Ausblick & Fazit

Blickt man über die Grenzen Europas hinaus, formen sich 2026 drei gewaltige Makro-Trends, die den deutschen Markt unausweichlich verändern werden. Aus Asien schwappt die Architektur für grenzüberschreitende Echtzeit-Settlements basierend auf regulierten Stablecoins und digitalen Zentralbankwährungen heran, was das traditionelle Korrespondenzbankensystem massiv unter Druck setzt. Die USA hingegen dominieren die Entwicklung der KI-gesteuerten autonomen Finanzen, bei der das Corporate Treasury von Algorithmen gesteuert wird, die ohne menschliches Zutun Liquidität verschieben. Aus Indien lernen wir, wie Identity-as-a-Service untrennbar mit dem Zahlungsverkehr verschmilzt und Betrug nahezu ausmerzt.

Für Gründer*innen und Investor*innen im DACH-Raum bedeutet dies: Der Fokus muss radikal auf Profitabilität, wasserdichter Compliance und extrem stabiler Infrastruktur liegen. Wer heute in Embedded Finance gewinnt, baut keine bunten Apps mehr, sondern die hochkomplexen, unsichtbaren Stahlträger der digitalen Weltwirtschaft.

KI-Baukasten für den Mittelstand: Kann firepanda.ai das Versprechen der Einfachheit halten?

Das Münchner Start-up firepanda.ai launcht neue Plattform-Features und ein überarbeitetes Preismodell. Mit prominenter Gründer-Erfahrung aus E-Commerce und IT will das Unternehmen den DACH-Mittelstand erobern. Doch wie zukunftssicher ist der Spagat zwischen Orchestrierung und „KI-Steuer“?

Die Integration künstlicher Intelligenz gleicht in vielen mittelständischen Betrieben aktuell noch einem Blindflug. Es fehlen oft Ressourcen für komplexe Implementierungen oder das Know-how zur Einhaltung von Datenschutzstandards. Genau in diese Lücke stößt die Münchner All-in-One-Plattform firepanda.ai. Was im Jahr 2022 als direkte Reaktion auf den globalen „ChatGPT-Moment“ innerhalb eines IT-Entwicklungsbüros begann, will mit einer aktualisierten Plattformversion den Marktzugang für den Mittelstand nun endgültig vereinfachen.

Vom „ChatGPT-Schock“ zum Agentur-Spin-off

Die Geschichte von firepanda.ai nahm ihren Lauf, als die Veröffentlichung von ChatGPT die Tech-Welt erschütterte. In der Münchner IT-Agentur Fireflow erkannten die Gründer sofort den massiven Bedarf – und die gleichzeitige Verunsicherung – bei ihren Kund*innen. Statt den Trend nur zu beobachten, entwickelte das Team in intensiven Konzeptionsphasen eine Lösung, die den deutschen Mittelstand sicher in das KI-Zeitalter führen soll. Anfang 2025 erfolgte dann der offizielle Launch.

Hinter diesem Spin-off stehen zwei Köpfe mit komplementären Profilen. Dr. Peter Dornbusch (CEO & CTO) ist promovierter Informatiker und DeepTech-Veteran mit über 25 Jahren IT-Erfahrung. Flankiert wird er von Daniel Kövary, einem Experten für Business Development und digitale Markenführung.

Auf die Frage, wie schwer der Spagat zwischen anspruchsvollem Agenturgeschäft und der Inkubation einer völlig neuen SaaS-Plattform war, räumt Kövary ein: „Es war zweifellos ein enormer Kraftakt, der sich jedoch als unser größter strategischer Vorteil erwies.“ Durch das Tagesgeschäft sei man extrem nah an den realen Schmerzpunkten der Kund*innen – wie Datenschutzbedenken und Ressourcenmangel – gewesen. Die lange Entwicklungszeit bis 2025 war dabei eine bewusste Entscheidung gegen schnelle halbe Sachen. „Wir wollten keine weitere dünne ‚Wrapper-App‘ auf den Markt bringen“, betont Kövary und fügt hinzu: „Durch KI-gestütztes Coding haben wir eine echte Zeitenwende erlebt und unsere Entwicklungszyklen bei herausragender Code-Qualität massiv verkürzt.“

Schluss mit dem KI-Flickenteppich

Die Kernidee von firepanda.ai ist ein modellagnostisches KI-Backend, das Nutzer*innen flexibel zwischen den Modellen von Anbietern wie OpenAI, Anthropic oder Google wählen lässt, ohne separate Verträge abschließen zu müssen. Ein entscheidender Hebel für den Vertrieb ist dabei die Datensicherheit, da die Plattform auf Servern in Deutschland gehostet wird.

Doch wie garantiert das Start-up rechtssicher, dass Daten bei der Nutzung von OpenAI nicht vom US-Cloud Act erfasst werden? Dr. Peter Dornbusch gibt sich hier kompromisslos: „Um höchste Datenschutzstandards zu gewährleisten, routen wir Anfragen an Modelle wie OpenAI nicht über die Standard-US-Schnittstellen, sondern ausschließlich über DSGVO-konforme Instanzen etablierter Anbieter wie Microsoft Azure oder AWS, die in Europa gehostet werden.“ Dabei würden strikte Zero-Data-Retention-Policies greifen, die verhindern, dass Kund*innendaten für das Modell-Training genutzt werden. Für Unternehmen mit extrem restriktiven Vorgaben bietet firepanda.ai zudem europäische Open-Source-Modelle wie Mistral an, die autark in Deutschland gehostet werden. „Der Kunde ist nicht in einem System gefangen, sondern behält die volle Souveränität“, resümiert der CTO.

KI-Agenten per Drag-and-drop

Um ohne Programmierkenntnisse spezifische KI-Assistenten zu konfigurieren, bietet die Plattform einen Workflow-Builder an, in dem/der Nutzer*in Trigger und Aktionen per Drag-and-drop verknüpfen.

Trotz dieser Versprechen mutieren viele B2B-Start-ups oft zu Beratungsagenturen, weil Kund*innen das Self-Serve-Prinzip nicht allein bewältigen. Daniel Kövary kennt dieses Problem: Die Wucht der Technologie überfordere aktuell noch viele Organisationen. Während globale Player wie Anthropic massiv gegensteuern und sogenannte Forward Deployed Engineers einsetzen, die Use Cases direkt in Unternehmen auf eigene Kosten umsetzen, wählt das Münchner Team einen anderen Pfad. „Da wir diesen extrem ressourcenintensiven Weg weder gehen können noch wollen, lautet unsere strategische Antwort: Enablement!“, stellt Kövary klar. Statt klassischem Handholding setzt man auf ein mehrstufiges Befähigungsmodell im Produkt – von abteilungsspezifischen Prompt-Bibliotheken für Anfänger*innen bis zum Workflow-Builder für Profis. Das Versprechen des Gründers: „Unser primäres Ziel im Onboarding ist es, unternehmensinterne ‚KI-Champions‘ auszubilden, die das Wissen als Multiplikatoren eigenständig skalieren.“

Transparenter Deal oder teure Skalierung?

Seit dem 1. März 2026 lockt firepanda.ai mit einer kostenlosen Testversion inklusive einer Million Token. Im produktiven Einsatz werden 19,95 Euro pro Nutzer*in im Monat fällig, während die Token-Kosten mit einem Handling-Aufschlag von zehn Prozent transparent weitergereicht werden. Zusatzmodule kosten extra: 395 Euro für Workflow-Automatisierung und 95 Euro für API-Anbindungen.

Bislang ist das Start-up komplett bootstrapped. Um die Infrastrukturkosten und die geplante Skalierung zu stemmen, sucht das Unternehmen nun aber sehr selektive Seed-Finanzierungen. Dornbusch sucht dabei explizit nicht nach klassischem Venture Capital, sondern nach „Smart Money“ von strategischen Business Angels. Das ehrgeizige Ziel: „Unser Meilenstein bei diesem kontrollierten Wachstum ist es, durch die anstehende Skalierungsphase bis Ende 2026 den Break-even zu erreichen.“

Die „KI-Steuer“-Falle und wartende Tech-Giganten

Kritiker*innen könnten den zehnprozentigen Token-Aufschlag bei hohen Datenmengen als kostspielige „KI-Steuer“ ansehen, was zur Abwanderung Richtung Direkt-APIs führen könnte. Zudem buhlen globale Wettbewerber wie Make.com oder Microsofts Copilot Studio um den Mittelstand.

Dornbusch wehrt sich gegen den Begriff der Steuer: „Wir sehen diesen zehnprozentigen Aufschlag keineswegs als ‚KI-Steuer‘, sondern als nachvollziehbare Service-Fee.“ Diese Marge decke die komplexe Orchestrierung sowie Compliance-Sicherheit ab und erspare mühsames Vertragsmanagement. Dass Kund*innen bei steigendem KI-Reifegrad abwandern, glaubt er nicht: „Wenn ein Unternehmen erst einmal komplexe Freigabeschleifen, RAG-Pipelines mit proprietären internen Daten und externe API-Trigger in firepanda.ai modelliert hat, wechselt es nicht wegen eines marginal günstigeren Token-Preises die Plattform.“

Und was passiert, wenn Microsoft seinen Copilot so tief integriert, dass externe KMU-Layer überflüssig werden? Kövary kontert, dass Copilot zwar gut für persönliche Produktivität sei, die reale Prozesslandschaft des Mittelstands aber weitaus komplexer. „Wir müssen aufhören, diesen Layer als dünne, überflüssige Benutzeroberfläche zu missverstehen – er ist vielmehr das schützende Betriebssystem eines jeden Unternehmens in der KI-Ära“, argumentiert er. Durch diese Architektur befreie man Kund*innen aus dem Vendor-Lock-in einzelner Großkonzerne.

Genialer Eisbrecher mit Ablaufdatum?

Für die ersten 12 bis 24 Monate der KI-Transformation ist firepanda.ai als technologischer Eisbrecher hochattraktiv. Langfristig muss sich allerdings zeigen, ob die eigenen Workflow-Logiken stark genug sind, um gegen die Marktmacht der großen Ökosysteme zu bestehen.

Gefragt nach der Zukunft und einem möglichen Exit winkt Dr. Peter Dornbusch ab. Die Backend-Entwicklung sei dank 20 Jahren Agenturerfahrung keine Hürde gewesen, sondern der größte strategische Hebel, um eine sichere Enterprise-Umgebung zu schaffen. Man sei gekommen, um zu bleiben: „Ein schneller Exit ist nicht unser Fokus, denn der europäische Markt für B2B-KI steht erst ganz am Anfang“, stellt der CTO klar und gibt die zukünftige Marschroute vor: „Wir bauen hier an einem nachhaltigen und unabhängigen ‚German AI Champion‘, der dem Mittelstand dauerhaft hilft, seine Produktivität messbar und zukunftssicher zu steigern.“

Schluss mit Swipen: Wie vibe deep aus Dating-Frust ein Relationship-Business machen will

Dating-Apps frustrieren, die Einsamkeit wächst. Das Hamburger Start-up vibe deep setzt daher auf „Deep Talk“ statt Swiping. Eine Analyse des neuen Geschäftsmodells, das beweisen will, dass sich mit emotionaler Tiefe ein skalierbares Tech-Unternehmen aufbauen lässt.

Die makroökonomischen und gesellschaftlichen Vorzeichen für eine Neuausrichtung digitaler sozialer Dienste sind eindeutig. Weltweit gilt laut der Weltgesundheitsorganisation (WHO) mittlerweile jede sechste Person als einsam. Allein in Deutschland geben über 42 Prozent der Bevölkerung an, in regelmäßigen Abständen Einsamkeit zu verspüren. Gleichzeitig zeigen klassische, auf raschen Konsum ausgelegte Dating-Apps massive Ermüdungserscheinungen. Die aktiven Nutzer*innenzahlen von Branchengrößen wie Tinder, Bumble und Hinge fielen im vierten Quartal 2024 global um sechs Prozent. Rund 69 Prozent aller heruntergeladenen Dating-Apps werden bereits innerhalb eines Monats wieder gelöscht.

Vor allem die junge Zielgruppe zieht Konsequenzen: Im Jahr 2024 planten 63 Prozent der Generation Z einen bewussten „Social-Media-Detox“ – mehr als jede andere Generation. Der Markt verlangt ganz offensichtlich nach echter Verbindung statt nach oberflächlichem, medialem Dopamin, welches das Fehlen realer Nähe oftmals nur vernebelt.

Genau in diese Lücke der wachsenden Dating-Ermüdung stößt die App vibe deep, mit der das Hamburger Start-up von Lui und Saskia Michalski den Fokus konsequent auf Deep Talk statt Swiping verschiebt.

Vom Content zum Tech-Produkt

Dabei war der Weg zum Tech-Unternehmen für die Gründer*innen, die zunächst als Content-Creator*innen im Bereich nicht-monogamer Lebensweisen erfolgreich wurden, keine klassische Laufbahn. Doch der Schritt in die Tech-Branche war eine logische Konsequenz aus dem wachsenden Frust ihrer Community. „Der Schlüsselmoment war eigentlich ein schleichender“, erinnert sich Saskia. Jahrelang hätten sie fehlende Tiefe und Einsamkeit thematisiert, doch die Probleme der Menschen seien eher gewachsen als geschrumpft. „Content allein bringt Menschen nicht ins Handeln“, konstatiert Saskia. „Er schafft Bewusstsein, aber keine echte Veränderung.“ Daraus sei der Entschluss gereift, ein Werkzeug zu bauen, das konkrete Interaktion ermöglicht.

Lui ergänzt: „Genau daraus ist vibe deep entstanden: als Produkt, nicht als Content-Verlängerung.“ Um das Vorhaben umzusetzen, übernahm er dank seines Hintergrunds in der Tech-Industrie das Product Management. Unterstützt werden die beiden von einem externen CTO, der die Entwicklung mit einem internationalen Team vorantreibt. Doch die Technik sei nur die halbe Miete: „Die eigentliche Innovation liegt nicht nur in der Technologie, sondern im Verständnis von Beziehungen – und genau das bringen wir als Gründer*innen mit“, betont Lui.

Deep Talk statt Dauerkonsum

Im Gegensatz zu bestehenden Plattformen, die auf die Quantität neuer Kontakte ausgelegt sind, setzt vibe deep auf die Intensivierung bereits bestehender Beziehungen. Der Mechanismus ist simpel, aber wirkungsvoll: Die App liefert den Nutzenden individuell angepasste Anregungen und stellt tiefgreifende psychologische Fragen – etwa zum persönlichen Umgang mit Konflikten. Der entscheidende Clou zur Steigerung des Engagements liegt darin, dass die Antworten erst ersichtlich werden, wenn alle beteiligten Parteien sich mit ihren eigenen Erwartungen auseinandergesetzt und diese in der App beantwortet haben.

Flankiert wird dieses Konzept von einer künstlichen Intelligenz, deren Nutzung jedoch streng an die Zustimmung aller Beteiligten geknüpft ist. Gerade beim Umgang mit hochsensiblen Paardaten stellt sich unweigerlich die Frage nach Datensicherheit. Auf Nachfrage versichert Lui strenge Standards: „Wir bauen kein Produkt, das ohne Vertrauen funktionieren kann.“ Er verweist auf Datensparsamkeit, pseudonymisierte Strukturen und die klare Regel, Inhalte nicht für das Training von KI-Modellen zu nutzen.

Saskia präzisiert den ethischen Rahmen der Technologie: Die KI sei darauf ausgelegt, „nicht zu bewerten oder Lösungen vorzugeben, sondern Verbindung zu fördern durch Spiegeln, Nachfragen und Perspektivwechsel“. Dabei bleiben die Algorithmen bewusst in einer unterstützenden, nicht-dominanten Rolle und greifen nur ein, wenn beide Partner*innen dies explizit wünschen. Den Kern ihres Anspruchs fasst Saskia pointiert zusammen: „Die intimsten Gespräche eines Menschen gehören nicht uns – wir dürfen nur den Raum dafür halten.“

Community-Power als Raketenstart im Haifischbecken

Mit über 600.000 Follower*innen über alle sozialen Netzwerke hinweg verfügt das Duo über eine immense organische Reichweite. Diese schlägt sich in den Startmetriken der App wider: In den ersten acht Wochen wurden bereits über 50.000 Fragen von den User*innen beidseitig beantwortet. Zudem verzeichnete die App in den ersten Wochen über 10.000 Installationen und konnte dabei mehr als 300 Premium-Aktivierungen vermerken.

Besonders bemerkenswert sind die emotionalen Erfolgsmetriken: Laut Unternehmensangaben bestätigen 75 Prozent der Nutzenden, dass sich ihr Verhältnis zueinander nach zehn Tagen signifikant verbessert hat. Ehrliche Kommunikation birgt jedoch auch Konsequenzen, denn laut denselben Daten endete jede zehnte Beziehung in diesem Zeitraum mit einer sofortigen Trennung.

Der Markt für „Relationship Care“ wächst und lockt international Wagniskapital an. Zu den Mitbewerbenden zählen das britische Start-up Paired sowie die US-amerikanischen Pendants Agapé und Coral. Im deutschsprachigen Raum konkurriert vibe deep unter anderem mit PAIRfect und recoupling, die durch TV-Show „Die Höhle der Löwen“ nationale Bekanntheit erlangten.

Doch wie grenzt man sich von diesen Millionen-Playern ab? „Viele der bestehenden Player bauen im Kern Therapie-Tools für romantische Zweierbeziehungen. Das bildet aber nur einen sehr kleinen Ausschnitt davon ab, was Beziehung eigentlich ist“, kritisiert Saskia Michalski. Vibe deep begreife Verbundenheit deutlich breiter – ob in Freundschaften, beim Dating oder in offenen Konstellationen. Tatsächlich nutze über die Hälfte der User*innen die App mit mehr als einer Person. „Deshalb bauen wir keine Therapie-App für Paare, sondern eine Infrastruktur für Verbindung“, resümiert Saskia.

Zwischen Viralität und Churn-Gefahr

Die Monetarisierung erfolgt derzeit über ein monatliches Abo-Modell, das dem Start-up verlässliche wiederkehrende Umsätze (MRR) sichern soll und tiefere Einblicke sowie mehr KI-Funktionen freischaltet. Für Lui war dieser erste Schritt ein erfolgreicher Test: „Die Frage war, ob Menschen grundsätzlich bereit sind, für tiefere Verbindung zu zahlen. Und die Antwort ist klar: Ja.“ Gleichzeitig räumt er ein, dass die App weniger als Daily-Produkt, sondern eher in intensiven emotionalen Peak-Phasen genutzt wird, weshalb man nun auch mit Wochen- und Jahres-Abos experimentiere. Finanziell agiert das Duo bislang völlig eigenständig („100% bootstrapped“), schließt aber externe Investor*innen für die nächste Wachstumsphase nicht aus. „In sechs Monaten können wir diese Frage also sicherlich schon deutlich präziser beantworten“, so Lui.

Das Geschäftsmodell ist ein klassisches Beispiel für die Monetarisierung innerhalb der Creator Economy. Durch die riesige Community bleiben die Akquisekosten extrem niedrig. Zudem erzeugt die Mechanik der zunächst verborgenen Antworten einen eingebauten Viral-Loop, der enorme Neugier weckt. Dennoch zeigen sich Skalierungsrisiken: Mit einer Conversion-Rate von rund drei Prozent muss vibe deep beweisen, dass es den Sprung aus der Influencer*innen-Blase in den Massenmarkt schafft.

Die größte Herausforderung bleibt das branchenbekannte „Churn-Paradoxon“: Löst die App ihr Versprechen ein und heilt die Beziehung – oder führt sie zur Trennung –, entfällt auf Dauer der primäre Use Case für die Endkonsument*innen.

Saskia widerspricht dieser Lesart jedoch energisch. Das Paradoxon basiere auf einem überholten Verständnis von Beziehungen, bei dem man ein Problem löst und dann „fertig“ sei. „Verbindung ist kein Zustand, den man einmal erreicht, sondern etwas, das sich ständig verändert“, analysiert Saskia. Weil die Nutzenden die App über mehrere Verbindungen und Lebensphasen hinweg nutzen, steige der Customer Lifetime Value ganz natürlich.

Perspektivisch plant das Start-up zudem Erweiterungen im B2B2C-Bereich, etwa als Begleit-Tool für Coaches und Paartherapeut*innen oder für das Team-Building in Unternehmen. Der Fokus bleibe vorerst jedoch auf den Endkonsument*innen. Saskia Michalski bringt die Vision selbstbewusst auf den Punkt: „Wir bauen kein Tool für ein Problem, das verschwindet, sondern für etwas, das immer wieder entsteht.“

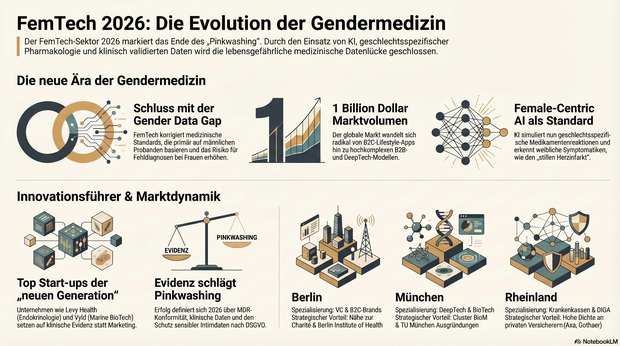

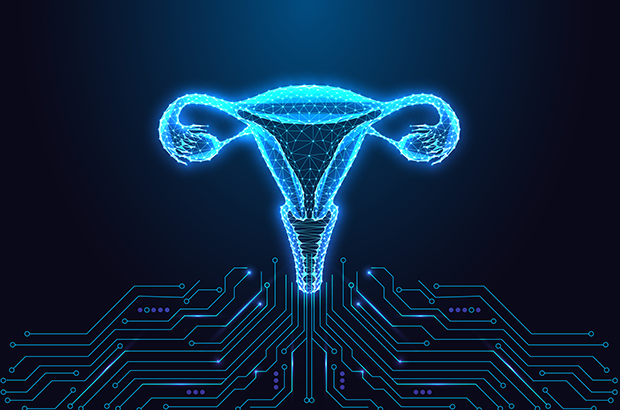

FemTech-Start-up-Report 2026

Schluss mit Pinkwashing! Wie deutsche FemTech-Start-ups 2026 die Gender Data Gap schließen und unser Gesundheitssystem neu codieren.

Lange Zeit belächelt, in eine rosarote Lifestyle-Ecke gedrängt und von männlich dominierten Investment-Komitees als Nischenthema abgetan: FemTech hat einen beispiellosen Reifeprozess hinter sich. Doch der eigentliche Paradigmenwechsel des Jahres 2026 findet tief in der Pharmakologie und der klinischen Forschung statt. Jahrzehntelang galt in der Medizin der 70 Kilogramm schwere Durchschnittsmann als universeller Standard. Die fatale Folge dieser sogenannten Gender Data Gap ist, dass Medikamente primär an männlichen Probanden getestet wurden, weshalb Frauen bis heute ein dramatisch höheres Risiko für Fehldiagnosen und schwere Nebenwirkungen tragen. Der weibliche Körper verstoffwechselt Wirkstoffe aufgrund hormoneller Zyklen und abweichender Enzymaktivitäten völlig anders. Vom einstigen Tabuthema zum DeepTech-Sektor beweist die Branche heute, dass geschlechtsspezifische Medizin kein Nischendasein mehr fristet, sondern ein systemkritisches Versäumnis korrigiert. FemTech schließt endlich diese lebensgefährliche Datenlücke und wird so zum unverzichtbaren Rückgrat einer gerechten, digitalen Medizin.

Datenpower gegen die medizinische Unsichtbarkeit

Der globale Markt für Frauengesundheit steuert laut aktuellen Analysen von McKinsey weltweit auf die Eine-Billion-Dollar-Marke zu. In Deutschland zeigt sich 2026 eine deutliche Konsolidierung. Während die Dealroom-Daten nach dem Hype der frühen 2020er Jahre zunächst eine Delle verzeichneten, hat sich das Investitionsvolumen in der DACH-Region mittlerweile auf einem konstant hohen Niveau stabilisiert. Laut einer Einschätzung der KfW fließen die Gelder heute jedoch smarter: Weg vom überfüllten B2C-Consumer-Markt, hin zu B2B-Modellen und DeepTech.

Der unangefochtene Haupttreiber in diesem Jahr ist die künstliche Intelligenz, die in der Diagnostik, bei der Mustererkennung von Biomarkern und vor allem in der Simulation geschlechtsspezifischer Medikamentenreaktionen neue Standards setzt. Series-A-Runden im zweistelligen Millionenbereich sind für wissenschaftlich validierte Geschäftsmodelle in Deutschland keine Seltenheit mehr, da die Erkenntnis gereift ist, dass eine Medizin, die die Hälfte der Menschheit ignoriert, schlichtweg ökonomisch ineffizient ist.

Gender-Pharmakologie und Female-Centric AI

Die FemTech-Welle der ersten Stunde wurde von Menstruations-Apps dominiert. Pioniere wie das Berliner Start-up Clue haben dafür den Weg bereitet. Doch 2026 dominieren völlig neue, hochkomplexe Sub-Sektoren das Feld. Erstens sehen wir einen massiven Push im Bereich der geschlechtsspezifischen Pharmakologie. Da der weibliche Metabolismus stark von Hormonzyklen beeinflusst wird, nutzen Start-ups heute synthetische Daten und KI, um virtuelle klinische Studien an weiblichen Profilen durchzuführen. Zweitens rückt die geschlechtsspezifische Kardiologie und Onkologie in den Fokus, bei der Algorithmen explizit auf weibliche Symptomatiken – wie den oft unerkannten „stillen Herzinfarkt“ bei Frauen – trainiert werden. Drittens boomt das Metabolische Biomonitoring, das präventiv Autoimmunerkrankungen trackt, die Frauen überproportional oft betreffen. Diese Entwicklung wird massiv durch Einrichtungen wie das Institut für Geschlechterforschung in der Medizin (GiM) an der Berliner Charité flankiert, das die klinische Gendermedizin maßgeblich vorantreibt.

Die Lektionen aus dem Crash der Lifestyle-Apps

Dass der Weg zur Profitabilität steinig ist, zeigte in der jüngeren Vergangenheit das spektakuläre Scheitern des US-Konzerns FemTec Health, der nach einer aggressiven Übernahmewelle – unter anderem des einstigen Schweizer Vorzeige-Start-ups Ava – grandios implodierte. Aus diesem Crash lassen sich für heutige Gründer*innen vier fatale Fallstricke ableiten. Der erste und wichtigste Fehler war die gnadenlose Unterschätzung der europäischen Medizinprodukteverordnung (MDR), die vielen Hardware-Produkten im Nachhinein das Genick brach. Zweitens offenbarten sich völlig zerstörte Unit Economics, da reine Direct-to-Consumer-Modelle durch exorbitante Marketingkosten unprofitabel wurden. Ein dritter Irrtum war das „Pinkwashing“: Es wurde mehr Budget in Lifestyle-Marketing gepumpt als in echte klinische Evidenz, was den Zugang zu essenziellen Krankenkassen-Erstattungen blockierte. Der vierte Fallstrick war die fehlende Spezialisierung auf Gender-Daten; Unternehmen, die lediglich eine weibliche Benutzeroberfläche für männliche Medizinstandards bauten, scheiterten am mangelnden medizinischen Mehrwert.

Wo die geschlechtsspezifische Innovation hierzulande pulsiert

Deutschlands FemTech-Landschaft konzentriert sich 2026 auf hochspezialisierte Hubs. Berlin bleibt der absolute Magnet für Venture Capital und B2C-Brands, stark befeuert durch die Nähe zur Charité und dem Berlin Institute of Health (BIH), das intensiv an der Schließung der Gender Data Gap arbeitet. München hat sich hingegen als das Epizentrum für DeepTech und BioTech etabliert, getragen von den exzellenten Ausgründungen der TU München und dem Cluster BioM. Ein oft unterschätzter, aber extrem relevanter Hotspot ist das Rheinland, insbesondere die Achse Köln/Bonn. Durch die hohe Dichte an privaten Krankenversicherern und Kooperationspartnern wie der Axa oder Gothaer ist dies der ideale Boden für Start-ups, die auf DiGA-Zulassungen schielen. Die Rhein-Neckar-Region um Heidelberg fungiert dank des Deutschen Krebsforschungszentrums (DKFZ) und dem Medizintechnologie-Cluster CUBEX in Mannheim als entscheidende Brücke zwischen harter Onkologie und frauenspezifischer Gesundheitsforschung.

Investor*innen-Radar

Die Investor*innenlandschaft hat sich massiv ausdifferenziert und gleicht 2026 einem hochprofessionellen Ökosystem. Auf der ersten Ebene agieren spezialisierte VCs wie der Auxxo Female Catalyst Fund oder Calm/Storm Ventures, die den Markt mit tiefer Expertise treiben. Die zweite Ebene bilden die Top-Tier Generalisten: Adressen wie Cherry Ventures, HV Capital und der spezialisierte Ableger Earlybird Health haben den ROI von FemTech längst erkannt. Drittens greifen Corporate VCs der Industrie massiv ein; hier positionieren sich Einheiten wie Bayer G4A oder der Roche Venture Fund frühzeitig, um sich strategische Innovationen im Diagnostikbereich zu sichern. Das Fundament bilden hochaktive Business Angels wie Gloria Bäuerlein, Gesa Miczaika und Startup-Verbands-Präsidentin Verena Pausder, die mit ihren Investments echte Signalwirkung erzeugen, während Syndikate wie encourageventures entscheidende Brücken in den Pre-Seed-Phasen bauen.

Die Top Start-ups (Must-Watch)

Für die folgende Auswahl der Top Start-ups des Jahres 2026 haben wir strenge Kriterien angelegt. Im Fokus stehen ausschließlich in Deutschland ansässige Unternehmen der „neuen Generation“ mit einem Gründungsjahr ab 2020. Wir bewerten die Marktrelevanz im Kontext der Gender-Medizin, den technologischen Reifegrad, das Vertrauen namhafter Lead-Investor*innen sowie die Fähigkeit, echte medizinische Datenlücken zu schließen. Die Redaktion hat diese Auswahl unabhängig und ohne finanzielle Gegenleistungen getroffen.

Levy Health (Gründung: 2021)

Das in Berlin gegründete Trio Caroline Mitterdorfer, Priv.-Doz. Dr. med. Theresa Vilsmaier und Silvia Hecher adressiert die komplexe Welt der Endokrinologie. Ihr B2B-SaaS-Produkt ist eine CE-zertifizierte Software zur klinischen Entscheidungsunterstützung, die Mediziner*innen hilft, die wahren Ursachen für weibliche Unfruchtbarkeit schneller zu entschlüsseln. Statt nur hormonelle Daten aufzubereiten, analysiert der Algorithmus umfassende klinische Parameter und Laborwerte, um eine massive diagnostische Lücke in der Reproduktionsmedizin zu schließen. Wie enorm das Skalierungspotenzial dieser Technologie ist, zeigte sich bei einer Seed-Runde über 4,5 Millionen US-Dollar: Angeführt vom US-Fonds XYZ Venture Capital und begleitet von Atlantic Labs, nutzte Levy Health das Kapital, um seinen Hauptsitz strategisch nach San Francisco zu verlegen – während Berlin die entscheidende europäische Entwicklungsbasis bleibt

Ovom Care (Gründung: 2023)

Felicia von Reden, die Gynäkologin Dr. Lynae Brayboy und die renommierte Embryologin Dr. Cristina Hickman heben die Reproduktionsmedizin mit Ovom Care auf ein neues Level. Das als Spin-off des Berliner KI-Studios Merantix gestartete Unternehmen verbindet reale physische Kinderwunschzentren – mit ersten Klinik-Standorten in Lissabon und Großbritannien – mit einer hochkomplexen Software zur Therapieplanung. Der USP: Der Algorithmus nutzt globale Patientinnendaten, um IVF-Behandlungen präzise auf den individuellen weiblichen Körper zuzuschneiden. Für diese technologische Schließung der Datenlücke sammelte das Start-up in einer Seed-Runde 4,8 Millionen Euro ein, angeführt vom Deep-Tech-VC Alpha Intelligence Capital (AIC) unter strategischer Beteiligung von Merantix und Ananda Impact Ventures.

Endo Health (Gründung: 2020)

Die Gynäkologin Dr. med. Nadine Rohloff und der Wirtschaftsinformatiker Markus Rothenhöfer (CIO) haben mit der in Chemnitz ansässigen Endo Health GmbH ein Unternehmen geschaffen, das sich lange Zeit exklusiv der Krankheit Endometriose widmete. Das Ursprungsmodell basiert auf der Endo-App, einer digitalen Gesundheitsanwendung (DiGA), die offiziell vom BfArM gelistet ist und auf Kassenkosten verschrieben werden kann. Im Jahr 2025 vollzog das Start-up jedoch den strategischen Sprung zur Multi-Disease-Plattform und launchte mit „Paula“ eine innovative App-Lösung für Betroffene des Polyzystischen Ovarialsyndroms (PCOS). Dieses enorme technologische Skalierungspotenzial für chronische Frauenkrankheiten überzeugte Geldgeber: Zu den Investoren der jüngsten Expansionsrunden zählen unter anderem Atreyu Investments, Cimexia GmbH, der Berlin Angel Fund und IBB Ventures.

Femfeel (Gründung: 2020)

Das Gründungstrio Janna Kraft, Marie Reger und Michaela Lehr widmet sich mit Femfeel der weiblichen Lebensmitte und überführt die Menopause in die digitale Versorgung. Ihr smartes B2B2C-Modell umgeht langwierige Rezept-Prozesse: Femfeel kombiniert App-basierte Begleitung mit evidenzbasierten Lebensstil-Interventionen, die offiziell als Präventionskurse (nach § 20 SGB V) zertifiziert sind und somit direkt von den Krankenkassen erstattet werden. Wie enorm wertvoll dieser präventive Markt geworden ist, bewies Femfeel durch einen hochbeachteten Exit: Das Start-up wurde von der Medice Health Family – einem Schwergewicht des deutschen Pharma-Mittelstands – übernommen und in dessen Digital-Health-Sparte integriert. Ein historisches Paradebeispiel dafür, wie stark die etablierte Industrie aktuell im FemTech-Sektor konsolidiert.

Frieda (Gründung: 2020)

Valentina Ullrich, Dr. med. Kai Schulze-Wundling und Thanh Schrader-Nguyen adressieren mit Frieda die Gendermedizin in der Menopause und gehen dabei tief in die klinische Diagnostik. Ursprünglich unter dem Namen Loba Health gestartet, agiert das Unternehmen heute als hybride digitale Klinik. Der USP: Statt den Östrogenabfall als Lifestyle-Thema abzutun, kombiniert Frieda datengestützte Telemedizin mit digitaler kognitiver Verhaltenstherapie (CBT) für eine evidenzbasierte Behandlung. Die Menopause wird hier als diagnostisches Fenster begriffen, um Gesundheitsdaten zur aktiven Prävention von altersbedingten Folgekrankheiten (wie Osteoporose) zu nutzen. Dieser konsequente Ansatz überzeugte auch den Schweizer Company Builder Maximon, der diese Brücke zur Langlebigkeit (Longevity) mit einem Seed-Investment von 2,5 Millionen Euro untermauerte.

Vyld (Gründung: 2021)

Ines Schiller und Melanie Schichan transformieren mit Vyld die Monatshygiene durch marine Biotechnologie. Das Start-up bietet sogenannte Kelpons aus Meeresalgen an. Dieser Rohstoff ist nicht nur radikal nachhaltig, sondern liefert einen massiven medizinischen USP: Algen sind von Natur aus hypoallergen, extrem saugfähig und kommen ohne schädliche Bleichmittel oder PFAS (Ewigkeitschemikalien) aus, was das empfindliche vaginale Mikrobiom aktiv schützt. Radikal ist bei Vyld auch die Struktur: Das Start-up agiert im Verantwortungseigentum (Steward-Ownership), wodurch Unternehmenszweck und Sicherheit stets vor kurzfristiger Gewinnmaximierung der Gesellschafter stehen. Dass dieser ethische DeepTech-Ansatz massiv skalieren kann, beweist die Finanzierung: Neben Impact-Investoren wie The Case for Her und millionenschweren Crowdinvesting-Instrumenten wird die Materialforschung von Vyld durch signifikante Fördermittel des Bundesministeriums für Bildung und Forschung (BMBF) validiert.

theblood (Gründung: 2022)

Das Gründerinnen-Duo Isabelle Guenou und Miriam Santer nutzt Menstruationsblut als diagnostische Goldmine. Ihr Geschäftsmodell basiert auf einer innovativen, nicht-invasiven Analyseplattform, die das lange tabuisierte Menstruationsblut nutzt, um ein breites Spektrum an Biomarkern – von Sexualhormonen bis hin zu essenziellen Nährstoffen wie Ferritin (Eisen) – zu tracken. Ein natürliches, zyklisches Abfallprodukt wird so zum hochwertigen Datensatz für die präventive Gesundheitsvorsorge, ganz ohne Nadelstich beim Arzt. Wie resilient und marktreif das Duo agiert, bewies es nach einem medienwirksam geplatzten TV-Investment („Die Höhle der Löwen“): theblood ließ sich nicht beirren und holte stattdessen hochkarätige strategische Partner an Bord. Dass dieser Ansatz massives Vertrauen genießt, zeigt die heutige Riege der Geldgeber: Neben Roosh Ventures und RoX Health investierte unter anderem Klosterfrau Ventures strategisch in die Berliner Pionierarbeit.

Internationaler Ausblick & Fazit

Der Blick über die deutschen Grenzen zeigt 2026 klar, in welche Richtung der Kompass navigiert. Aus den USA schwappt eine massive Welle der KI-basierten Wirkstoffentdeckung speziell für gynäkologische Erkrankungen nach Europa, während Asien die Hardware-Miniaturisierung für kontinuierliches Hormon-Tracking vorantreibt. Ein entscheidender globaler Makro-Trend ist jedoch die Souveränität der Intimdaten. In einer volatilen regulatorischen Ära in den USA (Post-Roe-v.-Wade) hat sich die europäische DSGVO vom Standortnachteil zum ultimativen Wettbewerbsvorteil entwickelt. Internationale Nutzerinnen suchen zunehmend Schutz bei europäischen Plattformen, die strikte Datensicherheit garantieren. Dies eröffnet deutschen Start-ups ungeahnte Exportchancen als absolute Vertrauensführer.

Für Gründer*innen und Investor*innen bedeutet dies: Die Zeit der reinen Wellness-Gadgets ist endgültig vorbei. Wer 2026 erfolgreich sein will, muss die Gender Data Gap schließen, klinische Evidenz liefern und den Datenschutz als ethisches Fundament begreifen. FemTech ist kein Nischen-Portfolio-Baustein mehr für die Diversity-Quote, sondern der am stärksten unterbewertete Treiber für die Zukunft der gesamten Gesundheitsökonomie. Wer heute in Gender-Medizin investiert, investiert in die Qualität der Medizin von morgen.

Blockchain-Start-up-Report 2026

Vorbei die Zeit der Krypto-Casinos: 2026 ist Blockchain das unsichtbare Betriebssystem der Wirtschaft. Die Top Start-ups, VCs und Trends im großen StartingUp-Report.

Es fühlt sich an wie ein anderes Zeitalter, wenn man auf die wilden frühen 2020er Jahre zurückblickt. Damals dominierten fliegende Hunde-Münzen wie Dogecoin, überteuerte Affen-Bilder des Bored Ape Yacht Club und toxische Goldgräberstimmung die Schlagzeilen. Heute, im Jahr 2026, hat die Blockchain-Technologie ihre Pubertät endgültig hinter sich gelassen. Der Wandel vom spekulativen Nischenthema zur unverzichtbaren Infrastruktur ist vollzogen. Wir sprechen nicht mehr über Krypto als Anlageklasse für Zocke*innen, sondern über distributed Ledger als das unsichtbare Betriebssystem der globalen Wirtschaft. Die Technologie ist leise geworden – und genau darin liegt ihr heutiger Wert für die Start-up-Welt.

Wenn Systemrelevanz auf MiCA trifft

Der europäische Markt für Web3- und Blockchain-Technologien hat einen nie dagewesenen Reifegrad erreicht. Der entscheidende Befreiungsschlag war die vollständige Implementierung der europäischen MiCA-Verordnung (Markets in Crypto-Assets), die den Kontinent vom regulatorischen Flickenteppich zum sichersten Hafen für institutionelles Kapital gemacht hat. Aktuelle Erhebungen des Bitkom und des KfW-Research zeigen, dass im Jahr 2026 bereits über 35 Prozent des deutschen Mittelstands die Technologie aktiv evaluieren oder Pilotprojekte mit Blockchain-Infrastruktur betreiben – primär im Supply-Chain-Management und der automatisierten Abrechnung.

Auf Investor*innenseite hat sich das Bild gewandelt: Statt Milliarden in unregulierte Token-Sales zu pumpen, fließen aktuell jährlich rund 1,8 Milliarden Euro klassisches Venture Capital in echte Equity-Runden der DACH-Region. Der absolute technologische Haupttreiber ist dabei die Konvergenz von künstlicher Intelligenz und Blockchain. Da KI-Agenten zunehmend autonom wirtschaftlich handeln, benötigen sie ein dezentrales, programmierbares und vor allem grenzenloses Zahlungssystem. Die Blockchain liefert exakt diese finanzielle Abwicklungsschicht für die Maschinenökonomie.

Die neuen Treiber jenseits der Krypto-Börsen

Wer heute noch Krypto-Exchanges oder reine NFT-Marktplätze baut, baut für die Vergangenheit. Der Markt des Jahres 2026 wird von drei hochspezifischen Sub-Sektoren dominiert, die das Internet grundlegend neu vernetzen.

- An vorderster Front steht DePIN (Decentralized Physical Infrastructure Networks). Hierbei wird reale Hardware – von Solarpanels bis hin zu 5G-Antennen – über Token-Incentives dezentral gesteuert und finanziert.

- Ebenso mächtig ist die Tokenisierung von Real World Assets (RWA), die den traditionellen Finanzmarkt revolutioniert, indem sie Anleihen, Immobilien und Kredite liquide auf die Chain bringt.