Aktuelle Events

Geschäftsideen Süßes: internationales Back-Mischwerk

Erfinderischer Bäcker

Die Dominique Ansel Bakery im New Yorker Stadtviertel SoHo bietet eine neue Kreation an, die Gründer Ansel sich sogar hat patentieren lassen: den Cronut. Dabei handelt es sich um eine Mischung aus Croissant und Donut. Eine süße Geschäftsidee!

Der Cronut wird aus Croissant-Teig hergestellt und hat die Form eines Donuts. Der Verkaufspreis je Stück beträgt 5 Dollar.

Nach eigenen Angaben hat Dominique Ansel Monate an dem Rezept und der Konsistenz des Cronuts gearbeitet. Pro Tag stellt er nur etwa 250 Stück her. Das Ergebnis sind lange Schlangen vor seinem Geschäft – z.T. schon ab 6 Uhr morgens. Damit möglichst viele Kunden noch einen Cronut erhalten, hat er die Zahl verkaufter Cronuts pro Person schon von sechs auf drei Stück reduziert. Das freut nicht jeden. Denn es gibt schon Leute, die sich nur in die Schlange vor der Dominique Ansel Bakery stellen, um die Cronuts anschließend an ihre Kunden auszuliefern. Dann kostet ein Cronut (inklusive Lieferung) bis zu 40 Dollar (pro Stück). Andere Personen kaufen drei Cronuts, um zwei gleich wieder vor dem Geschäft zu verkaufen.

Diese Artikel könnten Sie auch interessieren:

Produktivität statt Überstunden: Wie Echtzeitdaten das Finanzwesen von morgen steuern

Das KI-gestützte Fintech Embat beendet das Excel-Chaos im Treasury und macht Finanzteams mit Echtzeitdaten fit für die Zukunft.

Berlin, 28. April 2026 – Es ist ein bekanntes Bild in den Finanz- und Treasury-Abteilungen des deutschen Mittelstands: Wenn der Monatsabschluss naht oder Ad-hoc-Berichte für die Geschäftsführung benötigt werden, bleiben die Schreibtischlampen bis spät in die Nacht an. Die manuelle Zusammenführung von Daten aus unterschiedlichen Bankportalen und historisch gewachsenen Excel-Listen kostet nicht nur Nerven, sondern vor allem wertvolle Zeit.

Das schnell wachsende Fintech Embat tritt an, um genau diesen Engpass aufzulösen. André Reimers, Head of DACH, treibt diese Mission im deutschsprachigen Raum als Gesicht des Unternehmens voran. Seine Kernüberzeugung: Wer heute noch regelmäßig Überstunden machen muss, um finanzielle Transparenz zu schaffen, leidet nicht unter mangelnder Einsatzbereitschaft – er leidet unter einem strukturellen Datenproblem.

Beeindruckendes Wachstum durch das Lösen echter Pain Points

Dass der Schmerz in den Finanzabteilungen groß und der Bedarf an modernen Lösungen riesig ist, belegen die Zahlen, mit denen Embat den europäischen Markt aufrollt. Mit einem starken Kundenwachstum im deutschen Markt von über 250 Prozent im vergangenen Jahr und mittlerweile mehr als 400 mittelständischen und großen Unternehmenskunden weltweit hat sich das Fintech als fester Player etabliert. Das stetig wachsende Transaktionsvolumen von 250 Millionen Euro zeigt deutlich: Der Wechsel von fehleranfälligen Tabellen zu automatisierten Cloud-Lösungen ist in vollem Gange.

Der Weg aus der Excel-Falle

Mit seiner Technologie nimmt Embat den Kampf gegen ineffiziente Prozesse im Treasury auf. Anstatt hochqualifizierte Mitarbeiter mit repetitiver Datenpflege zu binden, automatisiert das System die Konsolidierung aller relevanten Finanzdaten.

„Die Erwartungshaltung, dass komplexe Finanzanalysen zwingend mit langen Abenden im Büro einhergehen müssen, ist schlichtweg nicht mehr zeitgemäß“, erklärt André Reimers. „Wenn Cashflow, Liquidität und Runways per Knopfdruck in Echtzeit abrufbar sind, ändert sich die gesamte Arbeitsdynamik. Finanzteams können aus dem reaktiven Modus heraustreten und sich auf die strategische Steuerung des Unternehmens konzentrieren.“

Hohe Innovationskraft trifft auf lokales DACH-Verständnis

Embat profitiert von einer enormen Innovationsgeschwindigkeit und Agilität, auf der die starke technologische Basis des Unternehmens beruht. Wie diese passgenau auf die spezifischen Bedürfnisse des deutschen Marktes übersetzt wird und für eine hohe lokale Marktpräsenz sorgt, zeigt André Reimers an den Standorten in München und Berlin.

Von diesen beiden Standorten aus steuert André Reimers das DACH-Geschäft und stellt das tiefe Verständnis für die komplexen Strukturen und hohen Sicherheitsbedürfnisse des deutschen Mittelstands sicher. Das Team zeigt dabei, wie moderne, dezentrale Zusammenarbeit erfolgreich funktioniert. Das Vertrauen der stetig wachsenden deutschen Kundenbasis fußt dabei auf dieser geballten lokalen Expertise gepaart mit der unerschütterlichen Zuverlässigkeit der Systeme.

Führen durch Resultate, nicht durch Anwesenheit

Die Botschaft an die Finanzwelt ist klar: Moderne Führung, hohe Produktivität und Skalierbarkeit erfordern keine starren Kontrollmechanismen oder endlosen Arbeitstage. Sie erfordern radikale Datentransparenz und die richtigen digitalen Werkzeuge. Wenn die Daten in Echtzeit fließen, sinkt die Fehlerquote, die Entscheidungsgeschwindigkeit steigt – und die systembedingten Überstunden im Treasury gehören endgültig der Vergangenheit an.

Über Embat:

Embat ist ein KI-gestütztes FinTech mit Schwerpunkt auf Treasury-Management, das es mittelständischen Unternehmen und Großkonzernen ermöglicht, ihre Finanzprozesse in Echtzeit zu zentralisieren. Gegründet von Antonio Berga und Carlos Serrano – ehemaligen J.P. Morgan-Managern mit umfassender Erfahrung im Corporate Banking – sowie Tomás Gil, dem ehemaligen CTO von Fintonic, entstand die Plattform mit der Mission, die Finanzabteilung zu digitalisieren. Die klare Prämisse dabei: Technologie von Finanzexperten für Finanzexperten.

Durch seine hybride Konnektivität lässt sich Embat in über 15.000 Banken und führende ERP-Systeme integrieren und beseitigt so jegliche Datenfragmentierung. Das wichtigste Alleinstellungsmerkmal ist TellMe, ein „Agentic Treasury Analyst“ (autonomer KI-Analyst), der Cashflow-Muster erkennt, komplexe Kontenabstimmungen automatisiert und strategische Entscheidungen zur Optimierung der Liquidität vorschlägt.

Mit Niederlassungen in Madrid, London, Berlin und München definiert Embat die Zukunft des Corporate Finance neu.

Württemberger Medien: Nachhaltige Wachstumsstrategien

Wie die Württemberger Medien Marketing Agentur Unternehmen mit datengetriebenen Strategien und klarer Positionierung unterstützt.

Digitale Sichtbarkeit ist heute für Unternehmen kein optionaler Erfolgsfaktor mehr, sondern eine Grundvoraussetzung. Märkte werden transparenter, Wettbewerber sichtbarer und Kunden anspruchsvoller. Wer sich behaupten will, muss nicht nur präsent sein, sondern gezielt kommunizieren, analysieren und optimieren. Genau an dieser Schnittstelle zwischen Strategie, Technologie und Kommunikation setzt die wtv Online Marketing Agentur an.

Das Unternehmen hat sich darauf spezialisiert, digitale Potenziale strukturiert zu erschließen und für seine Kunden messbar zu machen. Dabei geht es nicht um kurzfristige Maßnahmen oder einzelne Kampagnen, sondern um nachhaltige Strategien, die Wachstum langfristig unterstützen.

Von der Idee zur klaren digitalen Strategie

Viele Unternehmen starten mit einzelnen Marketingmaßnahmen, ohne eine übergeordnete Strategie zu verfolgen. Social-Media-Kanäle werden aufgebaut, Anzeigen geschaltet oder Inhalte produziert – oft ohne klare Zielsetzung oder langfristige Planung. Das Ergebnis: hohe Aufwände bei begrenzter Wirkung.

Die Württemberger Medien Agentur verfolgt bewusst einen anderen Ansatz. Im Mittelpunkt steht zunächst die Analyse. Bevor Maßnahmen umgesetzt werden, geht es darum, das Unternehmen, die Zielgruppe und den Markt genau zu verstehen.

Dazu gehören unter anderem:

- die Definition klarer Ziele und Zielgruppen

- die Analyse bestehender Marketingaktivitäten

- die Bewertung von Wettbewerbern und Marktposition

- die Identifikation von Potenzialen und Schwachstellen

Auf dieser Grundlage entsteht eine individuelle Strategie, die nicht nur kurzfristige Erfolge ermöglicht, sondern langfristig trägt.

Datenbasierte Entscheidungen statt Bauchgefühl

Ein wesentlicher Unterschied moderner Online-Marketing-Ansätze liegt in der Nutzung von Daten. Während Marketing früher oft stark von Erfahrung und Intuition geprägt war, stehen heute umfangreiche Analysemöglichkeiten zur Verfügung.

Die Württemberger Medien Agentur nutzt diese Möglichkeiten gezielt, um fundierte Entscheidungen zu treffen. Daten werden nicht nur gesammelt, sondern interpretiert und in konkrete Maßnahmen übersetzt. Dadurch lassen sich Maßnahmen kontinuierlich optimieren und Budgets effizient einsetzen.

Diese Arbeitsweise bringt mehrere Vorteile mit sich:

- bessere Planbarkeit von Marketingmaßnahmen

- transparente Erfolgsmessung

- gezielte Optimierung einzelner Kanäle

- langfristige Skalierbarkeit von Strategien

Gerade für wachsende Unternehmen ist diese Transparenz ein entscheidender Faktor.

Ganzheitlicher Blick auf digitale Kanäle

Online-Marketing besteht heute aus einer Vielzahl unterschiedlicher Disziplinen. Suchmaschinenoptimierung, Performance Marketing, Content-Strategie und Social Media greifen ineinander und beeinflussen sich gegenseitig.

Die Württemberger Medien Agentur betrachtet diese Bereiche nicht isoliert, sondern als Teil eines Gesamtsystems. Ziel ist es, die einzelnen Kanäle sinnvoll miteinander zu verknüpfen und so eine konsistente Markenkommunikation zu schaffen.

Dabei werden unter anderem folgende Bereiche integriert:

- Suchmaschinenoptimierung (SEO) für nachhaltige Sichtbarkeit

- Webdesign und Website-Entwicklung für einen professionellen digitalen Auftritt

- Digitale Mitarbeitergewinnung über zielgerichtete Online-Kampagnen

- Ganzheitliche strategische Beratung zur digitalen Sichtbarkeit und Kundengewinnung

Durch diese Verzahnung entsteht ein Marketingansatz, der sowohl kurzfristige Ergebnisse als auch langfristige Wirkung ermöglicht.

Fokus auf messbare Ergebnisse

Ein zentraler Anspruch der Württemberger Medien ist die Messbarkeit von Erfolg. Marketing wird nicht als kreativer Selbstzweck verstanden, sondern als strategisches Instrument zur Erreichung konkreter Unternehmensziele.

Das bedeutet, dass jede Maßnahme klar definierten Kennzahlen zugeordnet wird. Ob Traffic, Conversion-Rate oder Umsatz – die Ergebnisse werden kontinuierlich überprüft und ausgewertet.

Diese Transparenz schafft Vertrauen und ermöglicht es Kunden, ihre Investitionen nachvollziehbar zu steuern. Gleichzeitig bildet sie die Grundlage für eine kontinuierliche Weiterentwicklung der Strategie.

Zusammenarbeit auf Augenhöhe

Neben fachlicher Expertise spielt auch die Zusammenarbeit eine entscheidende Rolle. Die Württemberger Medien Agentur versteht sich nicht als externer Dienstleister im klassischen Sinne, sondern als strategischer Partner.

Das zeigt sich vor allem in der Kommunikation. Projekte werden eng mit den Kunden abgestimmt, Entscheidungen transparent getroffen und Entwicklungen regelmäßig besprochen. Ziel ist es, gemeinsam Lösungen zu entwickeln, die zum jeweiligen Unternehmen passen.

Diese partnerschaftliche Herangehensweise bringt mehrere Vorteile:

- klare Abstimmung von Zielen und Erwartungen

- schnelle Anpassung an Veränderungen

- langfristige Zusammenarbeit statt kurzfristiger Projekte

- bessere Integration in bestehende Unternehmensstrukturen

Gerade in dynamischen Märkten ist diese Flexibilität ein wichtiger Erfolgsfaktor.

Anpassungsfähigkeit in einem dynamischen Umfeld

Die digitale Welt verändert sich kontinuierlich. Neue Plattformen entstehen, Algorithmen werden angepasst und Nutzerverhalten entwickelt sich weiter. Für Unternehmen bedeutet das, dass Strategien regelmäßig überprüft und angepasst werden müssen.

Die Württemberger Medien Agentur begegnet dieser Dynamik mit einem flexiblen Ansatz. Statt starrer Konzepte setzt sie auf kontinuierliche Optimierung und Anpassung. Entwicklungen werden frühzeitig erkannt und in die Strategie integriert.

Dadurch bleiben Kunden nicht nur wettbewerbsfähig, sondern können neue Chancen aktiv nutzen.

Branchenübergreifende Erfahrung

Ein weiterer Vorteil der Württemberger Medien Online Marketing Agentur liegt in ihrer branchenübergreifenden Erfahrung. Zu den Kunden des Unternehmens zählen lokale und regionale Dienstleister, Handwerks- und Gewerbebetriebe sowie Unternehmen aus dem Mittelstand. Dadurch entsteht ein breites Verständnis für verschiedene Geschäftsmodelle, Zielgruppen und Marktmechaniken.

Diese Vielfalt hilft dabei, funktionierende Strategien nicht isoliert zu betrachten, sondern sinnvoll auf andere Bereiche zu übertragen. Was bei einem Dienstleistungsunternehmen zu mehr Sichtbarkeit und Anfragen führt, kann, richtig angepasst, auch für Handwerks- und Gewerbebetriebe sehr gut funktionieren. Gleichzeitig entstehen durch diese Perspektivwechsel oft innovative Ansätze, die über klassische Lösungen hinausgehen.

Dennoch bleibt jede Strategie individuell. Die Württemberger Medien Agentur setzt nicht auf standardisierte Konzepte, sondern passt Maßnahmen präzise an die jeweiligen Anforderungen an. Marktumfeld, Wettbewerbssituation und Zielgruppe werden dabei ebenso berücksichtigt wie interne Strukturen und Ressourcen des Kunden.

So entsteht ein ausgewogenes Verhältnis zwischen Erfahrung und Individualität – eine Kombination, die es ermöglicht, sowohl effizient als auch kreativ zu arbeiten und nachhaltige Ergebnisse zu erzielen.

Nachhaltiges Wachstum statt kurzfristiger Erfolge

Im Zentrum der Arbeit steht ein klares Ziel: nachhaltiges Wachstum. Während viele Marketingmaßnahmen auf schnelle Ergebnisse ausgerichtet sind, verfolgt die Württemberger Medien Agentur einen langfristigen Ansatz. Es geht nicht darum, kurzfristig Aufmerksamkeit zu erzeugen, sondern darum, stabile Strukturen aufzubauen, die dauerhaft funktionieren.

Das bedeutet, dass nicht nur einzelne Kampagnen optimiert werden, sondern das gesamte digitale Fundament eines Unternehmens gestärkt wird. Sichtbarkeit in Suchmaschinen, eine klare Markenpositionierung und eine gezielte Kundenansprache werden Schritt für Schritt aufgebaut und kontinuierlich weiterentwickelt.

Dabei spielen mehrere Faktoren zusammen. Eine technisch optimierte Website sorgt für eine bessere Auffindbarkeit, ein professioneller Markenauftritt stärkt die Außenwirkung und datenbasierte Kampagnen bringen gezielt Reichweite. Durch diese Kombination entsteht ein System, das nicht von einzelnen Maßnahmen abhängig ist, sondern als Ganzes wirkt.

Ein weiterer Vorteil dieses Ansatzes liegt in der Planbarkeit. Unternehmen erhalten eine klare Perspektive, wie sich ihre Marketingaktivitäten entwickeln und welche Ergebnisse realistisch zu erwarten sind. Gleichzeitig bleibt genügend Flexibilität, um auf Veränderungen im Markt zu reagieren und neue Chancen zu nutzen.

Dieser Fokus auf langfristige Entwicklung sorgt dafür, dass Unternehmen nicht nur kurzfristig wachsen, sondern sich nachhaltig im Wettbewerb positionieren können.

Fazit

Die Anforderungen an modernes Online-Marketing sind heute komplexer denn je. Unternehmen müssen sich in einem dynamischen Umfeld behaupten, ihre Zielgruppen verstehen und gleichzeitig effizient arbeiten. Gleichzeitig steigt der Druck, Marketingmaßnahmen nicht nur umzusetzen, sondern auch deren Wirkung nachvollziehbar zu machen.

Die Württemberger Medien Marketing Agentur zeigt, wie sich diese Herausforderungen strukturiert und zielgerichtet angehen lassen. Durch die Kombination aus datenbasierter Analyse, strategischer Planung und kontinuierlicher Optimierung entstehen Lösungen, die messbare Ergebnisse liefern und gleichzeitig langfristig tragen.

Besonders hervorzuheben ist der ganzheitliche Ansatz. Statt isolierter Maßnahmen entwickelt die Agentur ein umfassendes System, in dem alle digitalen Kanäle sinnvoll miteinander verknüpft sind. Dadurch wird nicht nur kurzfristige Sichtbarkeit erzeugt, sondern eine stabile Grundlage für nachhaltiges Wachstum geschaffen.

Für Unternehmen, die ihre digitale Präsenz gezielt ausbauen und langfristig stärken möchten, bietet dieser Ansatz eine klare Orientierung. Er verbindet Strategie, Technologie und Kommunikation zu einem durchdachten Gesamtbild – und schafft damit die Voraussetzungen für kontinuierlichen Erfolg in einem sich ständig verändernden Marktumfeld.

GovTech-Start-up Report 2026

Wir beleuchten, wie mutige Gründer*innen den steinigen Weg durch die Behördenflure meistern, welche Technologien den Markt dominieren und wo das smarte Kapital in diesem Jahr wirklich hinfließt.

Was in der DACH-Region lange als zäher Kampf um kleine GovTech-Pilotprojekte begann, hat sich zu einem hochprofessionellen und beispiellos erwachsenen Markt verdichtet. Befeuert durch die verpflichtende Umsetzung des Onlinezugangsgesetzes (OZG 2.0) – welches ab 2028 einen einklagbaren Rechtsanspruch für Bürgerinnen und Bürger verankert, anstatt auf direkte pauschale Sanktionen zu setzen – sowie den massiven Fachkräftemangel im öffentlichen Dienst, sind die Budgets für digitale Lösungen regelrecht explodiert.

Aktuelle Studien des Bitkom und Auswertungen von KfW Research aus dem Frühjahr 2026 belegen, dass Bund, Länder und Kommunen in diesem Jahr voraussichtlich über vier Milliarden Euro in Software-as-a-Service-Lösungen (SaaS) und Cloud-Infrastrukturen investieren werden, wobei hiervon neben etablierten IT-Dienstleistern zunehmend auch externe Start-ups profitieren. Der technologische Haupttreiber hat sich dabei drastisch verschoben: War es vor wenigen Jahren noch die reine Digitalisierung von PDF-Formularen, dominiert heute unangefochten die „Sovereign AI“ – also künstliche Intelligenz, die datenschutzkonform und auf eigenen europäischen Servern trainiert wird, um komplexe Verwaltungsakte in Sekundenbruchteilen zu prüfen und vorzubereiten.

Die Investitionssummen im europäischen GovTech-Sektor haben sich realisiert; wir sehen mittlerweile Series-B- und Series-C-Runden im hohen zweistelligen Millionenbereich, die beweisen, dass B2G (Business-to-Government) endgültig aus den Kinderschuhen herausgewachsen ist.

Jenseits des digitalen Bürgeramts

Wer heute von GovTech spricht, meint längst nicht mehr nur die Terminvergabe im Bürgeramt. Wichtig zur Einordnung ist hierbei vor allem ein gewaltiger Branchen-Crossover: An den Rändern verschmilzt der digitale Staat zunehmend mit den boomenden Sektoren DefenseTech und Cybersecurity – etwa wenn zivile Verwaltungssoftware plötzlich dual-use-fähig für das Beschaffungsamt der Bundeswehr skaliert wird oder kritische Behördeninfrastrukturen durch neue Cyber-Start-ups militärisch gehärtet werden. Da diese extrem kapitalintensiven Sicherheits-Bereiche jedoch völlig eigene Marktdynamiken besitzen, haben wir sie für unsere diesjährige Top-Start-up-Liste bewusst ausgeklammert; sie werden in eigenen, dedizierten StartingUp-Start-up-Reports tiefgehend analysiert.

Konzentrieren wir uns also auf das rein zivile GovTech, so wird der Markt in diesem Jahr von drei hochspezifischen Sub-Sektoren dominiert. An erster Stelle steht das Procurement-Tech, das den gigantischen öffentlichen Beschaffungsmarkt durch automatisierte Markterkundung und KI-Ausschreibungen radikal transparent macht. Dicht darauf folgt RegTech und Compliance Automation, um die Flut an neuen Regulierungen wie den EU AI Act in die Praxis umzusetzen. Als dritter Pfeiler hat sich CivicTech im Bereich der digitalen finanziellen und räumlichen Partizipation etabliert. Etablierte Pioniere haben hier den Weg geebnet: Polyteia hat sich als unverzichtbare Datenplattform für den öffentlichen Sektor bewiesen, während Nect mit seiner KI-gestützten Identitätsprüfung längst zum Goldstandard für den sicheren digitalen Bürgerzugang geworden ist.

Die Katerstimmung nach dem App-Goldrausch

Trotz der aktuellen Euphorie ist der Weg für GovTech-Gründer mit Gräbern gescheiterter Visionen gepflastert. Ein prominentes Beispiel für einen massiven Hype, der krachend in sich zusammenfiel, war die Ära der isolierten „Smart City Dashboards“ und Bürger*innen-Apps rund um die Jahre der Pandemie, allen voran der rasante Aufstieg und tiefe Fall der Luca App als staatlich finanzierte Contact-Tracing-Lösung. Als die öffentlichen Sondermittel versiegten, zeigte sich schonungslos, dass Geschäftsmodelle ohne tiefgreifende Integration in die kommunale IT-Architektur nicht überlebensfähig sind.

Aus diesen und ähnlichen Crashes lassen sich vier konkrete, fatale Fallstricke für heutige Gründer*innen ableiten. Erstens scheitern Start-ups reihenweise an der Unterschätzung der monatelangen öffentlichen Beschaffungszyklen (Vergaberecht), die jeden klassischen VC-Runway ausbrennen lassen. Zweitens verwechseln viele Gründer B2G mit B2C: Ein schickes Frontend reicht nicht, wenn die Unit Economics nicht stimmen und der Staat nicht pro Nutzer zahlt. Drittens zerschellen Skalierungshoffnungen an der kommunalen Kleinstaaterei, da die rund 11.000 deutschen Kommunen oft völlig autark entscheiden. Viertens und letztens unterschätzen Tech-Teams fast immer die harte IT-Regulatorik: Während auf kommunaler Ebene anfangs oft ISO-27001-Zertifizierungen und lückenlose DSGVO-Nachweise für Basis-Anwendungen ausreichen, ist das Fehlen der anspruchsvollen BSI-Grundschutz-Zertifizierung spätestens im Vertrieb an Bundesbehörden und kritische Infrastrukturen ein massives K.-o.-Kriterium.

Die deutschen Machtzentren der digitalen Republik

Die Landkarte der deutschen GovTech-Exzellenz ist im Jahr 2026 klar umrissen und konzentriert sich auf fünf absolute Hubs, in denen Wissenschaft, Verwaltung und Risikokapital symbiotisch verschmelzen. Berlin bleibt das politische und strategische Epizentrum, massiv befeuert durch den GovTech Campus Deutschland, der Ministerien und Start-ups physisch zusammenbringt, sowie die Hertie School, die als Kaderschmiede das nötige Verwaltungswissen beisteuert. München bildet den technologischen Gegenpol und fungiert als unangefochtene Speerspitze für DeepTech und LegalTech, getragen durch die Exzellenz der Technischen Universität München (TUM), das Center for Digital Technology and Management (CDTM) und den eigens ins Leben gerufenen Legal Tech Colab. Hamburg hat sich durch pragmatische Verwaltungsinnovationen an die Spitze gesetzt, wobei die Venture-Client-Einheit GovTecHH des Senats und die Nähe zur Bucerius Law School eine hochattraktive Testumgebung für RegTech-Gründer*innen bieten. Darmstadt sichert als vierter Hotspot das Fundament des digitalen Staates, da hier mit dem Fraunhofer-Institut für Sichere Informationstechnologie (SIT) und dem Forschungszentrum ATHENE die europäische Elite für Cybersicherheit und BSI-konforme Architekturen ausgebildet wird, ohne die kein GovTech-Start-up überleben kann.

Investor*innen-Radar

Das Kapital hat seine Scheu vor dem öffentlichen Sektor abgelegt und strukturiert sich 2026 in vier sehr professionelle Lager. Bei den spezialisierten VCs agieren Fonds wie Public.io oder Matterwave mittlerweile als absolute Experten, die nicht nur Geld, sondern vor allem unbezahlbare Zugänge in die verschachtelten Behördenstrukturen mitbringen. Auch die Top-Tier Generalisten haben den Markt für sich entdeckt: Renommierte Häuser wie Cherry Ventures und Earlybird, insbesondere über den an Universitäten gekoppelten Earlybird UNI-X Fund, leaden inzwischen kompetitive Runden im Deep-GovTech-Bereich. Eine essenzielle Brückenfunktion übernehmen die Corporate VCs und industrienahen Geldgeber; hier tritt vor allem der halbstaatliche High-Tech Gründerfonds (HTGF) als zentraler Türöffner und Gütesiegel für Folgefinanzierungen auf, dicht gefolgt von SAP.iO und Capgemini Ventures, die junge Lösungen in ihre gigantischen Behörden-Ausschreibungen integrieren. Den Nährboden dieses Ökosystems bilden jedoch die Frühphasen-Motoren und Business Angels, unter denen prominente Köpfe wie Verena Pausder, die massiv in digitale Bildungs- und Verwaltungsinfrastruktur investiert, sowie vernetzte Angel-Syndikate aus dem Umfeld des eco-Verbands, das erste Überlebenskapital und entscheidende Mentoring liefern

Die Top GovTech-Start-ups (Must-Watch)

Um die Spreu vom Weizen zu trennen, haben wir für unsere Must-Watch-Liste strengste Kriterien angelegt. Wie in Abschnitt 3 erläutert, haben wir DefenseTech und reine Cybersecurity-Start-ups für andere Ausgaben reserviert. Wir betrachten ausschließlich echte deutsche zivile GovTech-Start-ups, deren Gründung ab dem Jahr 2020 stattfand, um die neue Generation der Post-Pandemie-Gründer in den Fokus zu rücken. Die Auswahl basiert auf einer tiefgehenden Analyse der aktuellen Marktrelevanz, dem Reifegrad des Geschäftsmodells im harten B2G-Vertrieb, der technologischen Diversität sowie dem nachgewiesenen Investoren-Vertrauen in den letzten Finanzierungsrunden. Reine Beratungsagenturen oder Spin-offs von Großkonzernen wurden konsequent aussortiert.

GovRadar

Gegründet 2020 in München von Sascha Soyk und Daniel Faber, hat sich GovRadar der Entbürokratisierung des öffentlichen Einkaufs verschrieben. Das B2B/B2G-SaaS-Geschäftsmodell bietet eine Plattform, die öffentliche Beschaffungsprozesse und die obligatorische Markterkundung massiv automatisiert und vereinfacht. Der USP liegt in der rechtssicheren Erstellung von Vergabeunterlagen in einem Bruchteil der üblichen Zeit, was das Start-up schnell auf das Radar hochkarätiger Investoren brachte: In ihrer Seed-Runde sicherten sich die Gründer strategisches Kapital von prominenten Business Angels aus Wirtschaft und Politik, darunter Ex-Minister Karl-Theodor zu Guttenberg und Ex-Continental-Chef Wolfgang Reitzle.

GovMind

Im Jahr 2020 von Manuel Kilian in Berlin ins Leben gerufen, operiert GovMind heute faktisch als das "Bloomberg-Terminal" für den öffentlichen Sektor. Das Unternehmen agiert als hochspezialisierte B2B-Datenplattform, deren USP darin besteht, strukturierte Marktanalysen über das fragmentierte GovTech-Ökosystem bereitzustellen, damit Behörden überhaupt erst wissen, welche technologischen Innovationen existieren. Das Modell hat sich als derart unverzichtbares Recherche-Tool für Chief Digital Officer in Bund und Ländern etabliert, dass es zu einer der zentralen Exit-Stories der deutschen Szene wurde: Nach frühen Investments des renommierten GovTech-Fonds PUBLIC wurde das Start-up im Herbst 2024 vollständig von der etablierten GovTech Gruppe übernommen, um die Lösung unter industriellem Dach bundesweit zu skalieren.

Kertos

Das Münchner Start-up Kertos wurde Ende 2021 von Kilian Schmidt, Johannes Hussak und Alexander Prams gegründet und attackiert den massiven Pain Point der europäischen Bürokratie im Bereich RegTech. Das B2B-SaaS-Modell liefert ein Compliance-Betriebssystem, dessen herausragender USP eine KI-native No-Code-Plattform zur vollständigen, automatisierten Umsetzung von Datenschutz-Richtlinien (DSGVO) und Sicherheitsaudits ist. Die Schlagkraft dieser Technologie, die Unternehmen innerhalb weniger Tage für Regulierungen wie den AI Act "audit-ready" macht, bescherte dem Kertos-Team im September 2025 eine signifikante Series-A-Finanzierung über 14 Millionen Euro. Angeführt wurde diese aktuelle Runde vom globalen Investor Portage, flankiert von den treuen Bestandsinvestoren Pi Labs und Redstone.

Naro

Gegründet 2022 in Köln von Nils Krauthausen und Chris Püllen, operiert Naro heute an der hochkomplexen Schnittstelle zwischen FinTech und RegTech. Das Unternehmen, das ursprünglich als agiler ETF-Baukasten für Plattformen startete, bietet mittlerweile eine tiefgreifende B2B-Infrastruktur für rechtssichere Fonds- und Finanzprodukte. Genau dies bietet im Jahr 2026 zunehmend auch hochspannende Anwendungsfälle für staatliche Förderbanken, kommunale Anlagevehikel und komplexe Governance-Strukturen, da die Technologie die regulatorische Aufsetzung eigener Fonds radikal verkürzt. Das Vertrauen in dieses tiefe Infrastrukturmodell, das nach der frühen Begleitung durch La Famiglia (General Catalyst) massiv ausgebaut wurde, zeigte sich zuletzt Mitte 2025 in einer starken Seed-Finanzierung über fast 6 Millionen Euro, angeführt von den VCs Magnetic und Redstone.

JUPUS

René Fergen und Jannis Gebauer gründeten JUPUS im Jahr 2022 in Köln, um den juristischen Sektor ins KI-Zeitalter zu überführen. Das B2B-SaaS LegalTech fokussiert sich auf die KI-gestützte Automatisierung der Mandatsaufnahme und Aktenverwaltung, was als USP nicht nur für klassische Anwaltskanzleien, sondern zunehmend auch für chronisch überlastete staatliche Rechtsorgane und Notariate unverzichtbar ist. Die enorme Skalierbarkeit dieses Modells wurde zuletzt im Frühjahr 2025 durch eine massive Finanzierungsrunde über 6,5 Millionen Euro bestätigt. Als neuer Lead-Investor trat dabei Acton Capital auf, stark flankiert vom frühen Wegbegleiter und Bestandsinvestor, dem High-Tech Gründerfonds (HTGF).

Cityscaper

Im Jahr 2020 in Aachen von Sebastian Witt und Robin Römer gegründet, besetzt Cityscaper eine hochspannende Nische im Bereich CivicTech und kommunaler Stadtplanung. Das B2G-SaaS-Modell liefert eine Augmented-Reality-Plattform (AR), deren herausragender USP es ist, geplante städtebauliche Veränderungen für Bürgerinnen und Bürger direkt vor Ort via Smartphone dreidimensional erlebbar zu machen. Dieser demokratisierende Ansatz, der die klassische Bürgerbeteiligung radikal vereinfacht und teure Bau- und Planungsblockaden auflöst, überzeugte nicht nur schnell erste Modellkommunen, sondern sicherte dem Spin-off der RWTH Aachen auch frühzeitig strategisches Kapital durch branchenspezifische Business Angels und öffentliche Innovationsförderungen.

SUMM AI

Gegründet 2022 in München von Flora Geske, Vanessa Theel und Nicholas Wolf, löst SUMM AI ein gigantisches, oft übersehenes Problem der digitalen Verwaltung: Die gesetzliche Pflicht zur Barrierefreiheit. Das B2B/B2G-SaaS-Modell bietet quasi den universellen „DeepL-Übersetzer für Leichte Sprache“. Der herausragende USP der KI-basierten Plattform besteht darin, hochkomplexe, juristische Behördentexte auf Knopfdruck in leicht verständliche Sprache zu übersetzen. Dies ist angesichts strikter Inklusionsvorgaben für alle öffentlichen Stellen zwingend erforderlich und spart Kommunen Millionen an externen Agenturkosten. Das Fundament für den landesweiten Roll-out der Lösung in den Rathäusern legten die Gründer*innen bereits früh mit einer namhaften, siebenstelligen Finanzierungsrunde, getragen von etablierten Akteuren wie Venture Stars, jvh ventures und Müller Medien.

Ausblick & Fazit: Die nächste Welle rollt heran

Wenn wir den Blick über den deutschen Tellerrand hinaus auf das Jahr 2026 und darüber hinaus richten, zeichnen sich drei gewaltige globale Makro-Trends ab, die auch den europäischen GovTech-Markt unausweichlich verändern werden. Aus den USA schwappt ein massiver Crossover-Trend zwischen DefenseTech und GovTech nach Europa, bei dem Dual-Use-Technologien, die ursprünglich für die zivile Verwaltung gedacht waren, rasant für Sicherheits- und Verteidigungsbehörden skaliert werden. Gleichzeitig erzwingt die globale Strahlkraft der europäischen Gesetzgebung – allen voran der EU AI Act – einen internationalen Boom an Compliance-Automatisierungen, wodurch europäische RegTechs plötzlich zu Exportschlagern werden. Aus dem asiatischen Raum wiederum beobachten wir den unaufhaltsamen Siegeszug von CivicTech-Super-Apps, die staatliche Dienstleistungen, Payment und Bürgerbeteiligung in einer einzigen, extrem nutzer*innenfreundlichen Oberfläche bündeln und damit den Druck auf westliche Regierungen erhöhen, fragmentierte Portale endlich abzuschaffen.

Unser Fazit lautet: Die Zeit der geduldigen Pilotprojekte ist endgültig vorbei. Wer heute im GovTech-Sektor bestehen will, muss nicht nur brillante Technologie liefern, sondern vor allem die Ausdauer für komplexe Vergabezyklen und ein kompromissloses Verständnis für IT-Sicherheit mitbringen – denn der Staat von morgen verzeiht keine Systemausfälle mehr.

Fahrfuchs: Kein Führerschein, aber das Auto neu gedacht

Die Gründer Florian Ritzel und Jannik Kirchhoff aus Hamburg wollen das Problem der versteckten Autokosten lösen. Ihre App Fahrfuchs kletterte ohne Marketingbudget in die Top 100 der Finanz-Charts im App Store – eine klassische Bootstrapping-Erfolgsgeschichte. Doch wie tragfähig ist das Geschäftsmodell, wenn etablierte Konkurrenten den Markt beherrschen?

Während andere Abiturient*innen für Klausuren büffeln, programmierten Florian Ritzel und sein Mitgründer Jannik Kirchhoff (beide 18) ein Start-up. Die Initialzündung war laut den beiden Hamburger Gymnasiasten eine gesellschaftliche Beobachtung: Die Belastung durch Mobilitätskosten. „Die alleinerziehende Mutter sollte nicht an der Zapfsäule stehen müssen und entscheiden, ob sie ihr Kind in die Kita oder sich selbst zur Arbeit fährt“, beschreibt Ritzel die Motivation hinter dem Projekt. Die amüsante Ironie ihrer Gründung: Die Fahrfuchs-Gründer besitzen aktuell nicht einmal einen Führerschein.

Auf die naheliegende Skepsis bezüglich dieses fehlenden „Nutzer-Wissens“ reagiert Florian Ritzel offensiv: „Natürlich gibt es immer Leute, die unsere Idee kritisieren. Und fehlendes Nutzerwissen ist gerade am Anfang schwierig, vor allem, wenn man eine App bauen möchte, die möglichst vielen Menschen hilft.“ Doch aus der vermeintlichen Schwäche machten sie eine Stärke durch maximale Nutzerorientierung. „Wir haben bereits vorher im Umfeld rumgefragt, was die Leute eigentlich brauchen, und danach gezielt um Feedback gebeten“, erklärt der Gründer. Der Erfolg gibt ihnen recht: „Inzwischen erreichen uns täglich dutzende Mails mit Tipps – was die Nutzer*innen sich wünschen und wie wir die App verbessern können. Dadurch wird uns das Ganze nicht zum Verhängnis, sondern sogar zum Vorteil.“

Mit Fahrfuchs wollen sie den rund 48,5 Millionen Pkw-Halter*innen in Deutschland auf den Cent genau aufzeigen, wo das Auto wirklich Geld frisst. Denn der teure Kraftstoff ist nur ein Teil der Wahrheit. Falsche Versicherungstarife, unbemerkter Wertverlust, Wartung und vergessene Pendlerpauschalen reißen oft weitaus größere Löcher ins Budget. Die Resonanz ist für die frühe Phase beachtlich: Ganz ohne bezahltes Marketing sammelte die App schnell über 700 Downloads ein – eine für den Massenmarkt zwar noch bescheidene Zahl, die jedoch ausreichte, um mehrfach in die Top 100 der Finanz-Charts im App Store zu stürmen. Zudem generierte das Projekt rein organisch Presseberichte, unter anderem in der FAZ, der SWP und bei Antenne Bayern.

Holistischer Ansatz statt reiner Tank-App

Auf den ersten Blick wirkt Fahrfuchs wie ein weiterer Spritpreis-Radar. Die App zieht in Echtzeit Daten der Markttransparenzstelle für Kraftstoffe, listet Ladesäulen für E-Autos und alarmiert per Push-Nachricht bei günstigen Preisen. Der entscheidende Pivot ist jedoch das ganzheitliche Kostentracking: Die Gründer haben einen eigenen Versicherungsrechner sowie einen Steuer-Sparrechner integriert, bieten detaillierte Monatsreports an und binden die Nutzer*innen über einen Gamification-Ansatz („Sparfuchs-Score“). Ein zentrales Versprechen in Zeiten von Datenskandalen: Alle sensiblen Nutzer*innendaten werden lokal auf dem Endgerät gespeichert – es gibt keine zentrale Cloud.

Angesprochen auf die Skalierbarkeit dieses Modells bezieht Jannik Kirchhoff klar Stellung: „Die lokale Datenspeicherung ist gerade in Deutschland kein strategisches Eigentor. Ich halte nichts für wichtiger, als die privaten Daten unserer Nutzer*innen zu schützen“. Er warnt vor den Risiken zentraler Speicherlösungen: „Niemand muss wissen, wo ich wohne, wohin ich morgens fahre oder wo meine Kinder zur Kita gehen. Wir haben in der Vergangenheit immer wieder gesehen, dass jeder gehackt werden kann. Und gerade als junge Entwickler können und wollen wir diese Verantwortung nicht übernehmen“. Personalisierte Spar-Vorschläge ließen sich laut Kirchhoff auch direkt auf dem Smartphone „hervorragend realisieren“.

Ein echtes Haifischbecken

Die Vision ist ambitioniert, doch der Markt ist hart umkämpft. Die Konkurrenz reicht von Excel-Tabellen bis zu Platzhirschen wie Spritmonitor oder Giganten wie Clever Tanken. Warum also wechseln? Florian Ritzel gibt sich selbstbewusst: „Die Spritpreis-Übersicht ist bei uns nur eines von vielen Features – nicht der Hauptteil. Wer Spritmonitor so gut findet, darf dort gerne bleiben.“ Der Fokus liege woanders: „Wer aber wirklich tracken möchte, was sein Auto insgesamt kostet, der kann das eben nur bei uns. Diese Gesamtheit an Features gibt es bisher in keiner anderen App in dieser Form.“ Selbst das Argument der manuellen Excel-Tabelle lässt er nicht gelten: „Natürlich kann man sich das selbst in Excel bauen – aber darauf haben die meisten Leute schlicht keine Lust. Genau deswegen sind wir so gut.“

Kritisch hinterfragt

Trotz des Aufklärungscharakters ist Fahrfuchs kein reines Hobbyprojekt; In-App-Käufe für eine „Plus“-Version (0,99 €/Monat) sowie eine „Pro“-Version (2,99 €/Monat bzw. 19,99 €/Jahr) bilden das Monetarisierungsmodell. Ob die selbstgestrickte Mathematik hinter dem Versicherungsrechner, der auf hunderten per Hand durchgerechneten Profilen basiert, ohne echte API-Schnittstellen dauerhaft standhält, bleibt abzuwarten.

Wie viele Abonnent*innen braucht es, um nach dem Abitur davon zu leben? Jannik Kirchhoff rechnet vor: „Ehrlicherweise vermutlich mehr als 10.000 zahlende Abonnent*innen – aber das ist zunächst auch nicht unser Ziel.“ Aktuell stehe das Lernen im Vordergrund: „Wir wollen vor allem Erfahrungen sammeln durch das, was wir machen, und gleichzeitig die laufenden Kosten decken. Das sollte demnächst möglich sein.“

Für die Zeit nach dem Abschluss hält er sich alle Türen offen: „Risikokapital halte ich ab dem Moment für unumgänglich, an dem wir wirklich konkret expandieren wollen. Das wird vermutlich nach dem Abitur der Fall sein. Dann muss man schauen, ob es sich lohnt, Anteile abzugeben oder Kredite aufzunehmen.“ Sein Fazit: „Spannend wird es erst, wenn wir die Idee wirklich groß skalieren wollen.“

Ein exzellentes MVP mit Pivot-Potenzial

Fahrfuchs ist ein Lehrbuchbeispiel für ein hervorragendes Minimum Viable Product (MVP). Um jedoch hochprofitabel zu werden, könnte mittelfristig ein Wechsel hin zur Affiliate-Provision für Versicherungswechsel nötig sein. Doch hier bremst Florian Ritzel bewusst: „Versicherungspartner wollen wir zunächst bewusst nicht werden, denn einer der entscheidendsten Punkte unserer App ist, dass wir Versicherungsdaten unabhängig zur Verfügung stellen.“

Sein Ziel ist technologische Exzellenz: „Meilenstein eins ist, den Versicherungsrechner so akkurat zu machen, dass wir auf Check24-Niveau sind – ohne dafür Provisionen zu kassieren.“ Zudem plane man Kooperationen mit Fahrschulen und Werkstätten, um die Leute genau dort zu erreichen, „wo sie am meisten ans Auto denken“. Die größte Hürde bleibt derweil technischer Natur: „Meilenstein drei ist die Android-Version – das ist allerdings extrem schwer umzusetzen, gerade wenn man iOS-Coding gewohnt ist.“ Dennoch verspricht er: „Wir planen das aber innerhalb der nächsten drei Monate.“

Der Grundstein ist gelegt. Nun müssen die beiden Hamburger beweisen, dass sie nach dem Abitur nicht nur programmieren, sondern auch unternehmerisch durch den dichten Verkehr des Mobilitätsmarktes navigieren können.

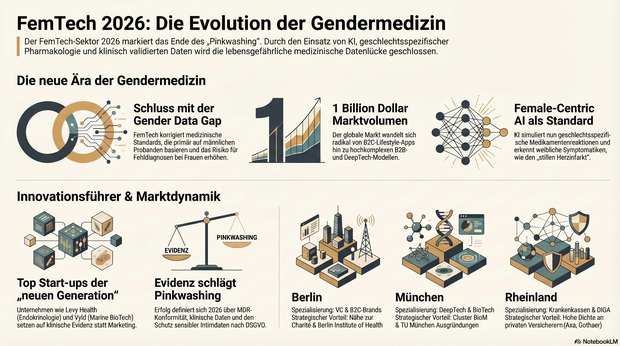

FemTech-Start-up-Report 2026

Schluss mit Pinkwashing! Wie deutsche FemTech-Start-ups 2026 die Gender Data Gap schließen und unser Gesundheitssystem neu codieren.

Lange Zeit belächelt, in eine rosarote Lifestyle-Ecke gedrängt und von männlich dominierten Investment-Komitees als Nischenthema abgetan: FemTech hat einen beispiellosen Reifeprozess hinter sich. Doch der eigentliche Paradigmenwechsel des Jahres 2026 findet tief in der Pharmakologie und der klinischen Forschung statt. Jahrzehntelang galt in der Medizin der 70 Kilogramm schwere Durchschnittsmann als universeller Standard. Die fatale Folge dieser sogenannten Gender Data Gap ist, dass Medikamente primär an männlichen Probanden getestet wurden, weshalb Frauen bis heute ein dramatisch höheres Risiko für Fehldiagnosen und schwere Nebenwirkungen tragen. Der weibliche Körper verstoffwechselt Wirkstoffe aufgrund hormoneller Zyklen und abweichender Enzymaktivitäten völlig anders. Vom einstigen Tabuthema zum DeepTech-Sektor beweist die Branche heute, dass geschlechtsspezifische Medizin kein Nischendasein mehr fristet, sondern ein systemkritisches Versäumnis korrigiert. FemTech schließt endlich diese lebensgefährliche Datenlücke und wird so zum unverzichtbaren Rückgrat einer gerechten, digitalen Medizin.

Datenpower gegen die medizinische Unsichtbarkeit

Der globale Markt für Frauengesundheit steuert laut aktuellen Analysen von McKinsey weltweit auf die Eine-Billion-Dollar-Marke zu. In Deutschland zeigt sich 2026 eine deutliche Konsolidierung. Während die Dealroom-Daten nach dem Hype der frühen 2020er Jahre zunächst eine Delle verzeichneten, hat sich das Investitionsvolumen in der DACH-Region mittlerweile auf einem konstant hohen Niveau stabilisiert. Laut einer Einschätzung der KfW fließen die Gelder heute jedoch smarter: Weg vom überfüllten B2C-Consumer-Markt, hin zu B2B-Modellen und DeepTech.

Der unangefochtene Haupttreiber in diesem Jahr ist die künstliche Intelligenz, die in der Diagnostik, bei der Mustererkennung von Biomarkern und vor allem in der Simulation geschlechtsspezifischer Medikamentenreaktionen neue Standards setzt. Series-A-Runden im zweistelligen Millionenbereich sind für wissenschaftlich validierte Geschäftsmodelle in Deutschland keine Seltenheit mehr, da die Erkenntnis gereift ist, dass eine Medizin, die die Hälfte der Menschheit ignoriert, schlichtweg ökonomisch ineffizient ist.

Gender-Pharmakologie und Female-Centric AI

Die FemTech-Welle der ersten Stunde wurde von Menstruations-Apps dominiert. Pioniere wie das Berliner Start-up Clue haben dafür den Weg bereitet. Doch 2026 dominieren völlig neue, hochkomplexe Sub-Sektoren das Feld. Erstens sehen wir einen massiven Push im Bereich der geschlechtsspezifischen Pharmakologie. Da der weibliche Metabolismus stark von Hormonzyklen beeinflusst wird, nutzen Start-ups heute synthetische Daten und KI, um virtuelle klinische Studien an weiblichen Profilen durchzuführen. Zweitens rückt die geschlechtsspezifische Kardiologie und Onkologie in den Fokus, bei der Algorithmen explizit auf weibliche Symptomatiken – wie den oft unerkannten „stillen Herzinfarkt“ bei Frauen – trainiert werden. Drittens boomt das Metabolische Biomonitoring, das präventiv Autoimmunerkrankungen trackt, die Frauen überproportional oft betreffen. Diese Entwicklung wird massiv durch Einrichtungen wie das Institut für Geschlechterforschung in der Medizin (GiM) an der Berliner Charité flankiert, das die klinische Gendermedizin maßgeblich vorantreibt.

Die Lektionen aus dem Crash der Lifestyle-Apps

Dass der Weg zur Profitabilität steinig ist, zeigte in der jüngeren Vergangenheit das spektakuläre Scheitern des US-Konzerns FemTec Health, der nach einer aggressiven Übernahmewelle – unter anderem des einstigen Schweizer Vorzeige-Start-ups Ava – grandios implodierte. Aus diesem Crash lassen sich für heutige Gründer*innen vier fatale Fallstricke ableiten. Der erste und wichtigste Fehler war die gnadenlose Unterschätzung der europäischen Medizinprodukteverordnung (MDR), die vielen Hardware-Produkten im Nachhinein das Genick brach. Zweitens offenbarten sich völlig zerstörte Unit Economics, da reine Direct-to-Consumer-Modelle durch exorbitante Marketingkosten unprofitabel wurden. Ein dritter Irrtum war das „Pinkwashing“: Es wurde mehr Budget in Lifestyle-Marketing gepumpt als in echte klinische Evidenz, was den Zugang zu essenziellen Krankenkassen-Erstattungen blockierte. Der vierte Fallstrick war die fehlende Spezialisierung auf Gender-Daten; Unternehmen, die lediglich eine weibliche Benutzeroberfläche für männliche Medizinstandards bauten, scheiterten am mangelnden medizinischen Mehrwert.

Wo die geschlechtsspezifische Innovation hierzulande pulsiert

Deutschlands FemTech-Landschaft konzentriert sich 2026 auf hochspezialisierte Hubs. Berlin bleibt der absolute Magnet für Venture Capital und B2C-Brands, stark befeuert durch die Nähe zur Charité und dem Berlin Institute of Health (BIH), das intensiv an der Schließung der Gender Data Gap arbeitet. München hat sich hingegen als das Epizentrum für DeepTech und BioTech etabliert, getragen von den exzellenten Ausgründungen der TU München und dem Cluster BioM. Ein oft unterschätzter, aber extrem relevanter Hotspot ist das Rheinland, insbesondere die Achse Köln/Bonn. Durch die hohe Dichte an privaten Krankenversicherern und Kooperationspartnern wie der Axa oder Gothaer ist dies der ideale Boden für Start-ups, die auf DiGA-Zulassungen schielen. Die Rhein-Neckar-Region um Heidelberg fungiert dank des Deutschen Krebsforschungszentrums (DKFZ) und dem Medizintechnologie-Cluster CUBEX in Mannheim als entscheidende Brücke zwischen harter Onkologie und frauenspezifischer Gesundheitsforschung.

Investor*innen-Radar

Die Investor*innenlandschaft hat sich massiv ausdifferenziert und gleicht 2026 einem hochprofessionellen Ökosystem. Auf der ersten Ebene agieren spezialisierte VCs wie der Auxxo Female Catalyst Fund oder Calm/Storm Ventures, die den Markt mit tiefer Expertise treiben. Die zweite Ebene bilden die Top-Tier Generalisten: Adressen wie Cherry Ventures, HV Capital und der spezialisierte Ableger Earlybird Health haben den ROI von FemTech längst erkannt. Drittens greifen Corporate VCs der Industrie massiv ein; hier positionieren sich Einheiten wie Bayer G4A oder der Roche Venture Fund frühzeitig, um sich strategische Innovationen im Diagnostikbereich zu sichern. Das Fundament bilden hochaktive Business Angels wie Gloria Bäuerlein, Gesa Miczaika und Startup-Verbands-Präsidentin Verena Pausder, die mit ihren Investments echte Signalwirkung erzeugen, während Syndikate wie encourageventures entscheidende Brücken in den Pre-Seed-Phasen bauen.

Die Top Start-ups (Must-Watch)

Für die folgende Auswahl der Top Start-ups des Jahres 2026 haben wir strenge Kriterien angelegt. Im Fokus stehen ausschließlich in Deutschland ansässige Unternehmen der „neuen Generation“ mit einem Gründungsjahr ab 2020. Wir bewerten die Marktrelevanz im Kontext der Gender-Medizin, den technologischen Reifegrad, das Vertrauen namhafter Lead-Investor*innen sowie die Fähigkeit, echte medizinische Datenlücken zu schließen. Die Redaktion hat diese Auswahl unabhängig und ohne finanzielle Gegenleistungen getroffen.

Levy Health (Gründung: 2021)

Das in Berlin gegründete Trio Caroline Mitterdorfer, Priv.-Doz. Dr. med. Theresa Vilsmaier und Silvia Hecher adressiert die komplexe Welt der Endokrinologie. Ihr B2B-SaaS-Produkt ist eine CE-zertifizierte Software zur klinischen Entscheidungsunterstützung, die Mediziner*innen hilft, die wahren Ursachen für weibliche Unfruchtbarkeit schneller zu entschlüsseln. Statt nur hormonelle Daten aufzubereiten, analysiert der Algorithmus umfassende klinische Parameter und Laborwerte, um eine massive diagnostische Lücke in der Reproduktionsmedizin zu schließen. Wie enorm das Skalierungspotenzial dieser Technologie ist, zeigte sich bei einer Seed-Runde über 4,5 Millionen US-Dollar: Angeführt vom US-Fonds XYZ Venture Capital und begleitet von Atlantic Labs, nutzte Levy Health das Kapital, um seinen Hauptsitz strategisch nach San Francisco zu verlegen – während Berlin die entscheidende europäische Entwicklungsbasis bleibt

Ovom Care (Gründung: 2023)

Felicia von Reden, die Gynäkologin Dr. Lynae Brayboy und die renommierte Embryologin Dr. Cristina Hickman heben die Reproduktionsmedizin mit Ovom Care auf ein neues Level. Das als Spin-off des Berliner KI-Studios Merantix gestartete Unternehmen verbindet reale physische Kinderwunschzentren – mit ersten Klinik-Standorten in Lissabon und Großbritannien – mit einer hochkomplexen Software zur Therapieplanung. Der USP: Der Algorithmus nutzt globale Patientinnendaten, um IVF-Behandlungen präzise auf den individuellen weiblichen Körper zuzuschneiden. Für diese technologische Schließung der Datenlücke sammelte das Start-up in einer Seed-Runde 4,8 Millionen Euro ein, angeführt vom Deep-Tech-VC Alpha Intelligence Capital (AIC) unter strategischer Beteiligung von Merantix und Ananda Impact Ventures.

Endo Health (Gründung: 2020)

Die Gynäkologin Dr. med. Nadine Rohloff und der Wirtschaftsinformatiker Markus Rothenhöfer (CIO) haben mit der in Chemnitz ansässigen Endo Health GmbH ein Unternehmen geschaffen, das sich lange Zeit exklusiv der Krankheit Endometriose widmete. Das Ursprungsmodell basiert auf der Endo-App, einer digitalen Gesundheitsanwendung (DiGA), die offiziell vom BfArM gelistet ist und auf Kassenkosten verschrieben werden kann. Im Jahr 2025 vollzog das Start-up jedoch den strategischen Sprung zur Multi-Disease-Plattform und launchte mit „Paula“ eine innovative App-Lösung für Betroffene des Polyzystischen Ovarialsyndroms (PCOS). Dieses enorme technologische Skalierungspotenzial für chronische Frauenkrankheiten überzeugte Geldgeber: Zu den Investoren der jüngsten Expansionsrunden zählen unter anderem Atreyu Investments, Cimexia GmbH, der Berlin Angel Fund und IBB Ventures.

Femfeel (Gründung: 2020)

Das Gründungstrio Janna Kraft, Marie Reger und Michaela Lehr widmet sich mit Femfeel der weiblichen Lebensmitte und überführt die Menopause in die digitale Versorgung. Ihr smartes B2B2C-Modell umgeht langwierige Rezept-Prozesse: Femfeel kombiniert App-basierte Begleitung mit evidenzbasierten Lebensstil-Interventionen, die offiziell als Präventionskurse (nach § 20 SGB V) zertifiziert sind und somit direkt von den Krankenkassen erstattet werden. Wie enorm wertvoll dieser präventive Markt geworden ist, bewies Femfeel durch einen hochbeachteten Exit: Das Start-up wurde von der Medice Health Family – einem Schwergewicht des deutschen Pharma-Mittelstands – übernommen und in dessen Digital-Health-Sparte integriert. Ein historisches Paradebeispiel dafür, wie stark die etablierte Industrie aktuell im FemTech-Sektor konsolidiert.

Frieda (Gründung: 2020)

Valentina Ullrich, Dr. med. Kai Schulze-Wundling und Thanh Schrader-Nguyen adressieren mit Frieda die Gendermedizin in der Menopause und gehen dabei tief in die klinische Diagnostik. Ursprünglich unter dem Namen Loba Health gestartet, agiert das Unternehmen heute als hybride digitale Klinik. Der USP: Statt den Östrogenabfall als Lifestyle-Thema abzutun, kombiniert Frieda datengestützte Telemedizin mit digitaler kognitiver Verhaltenstherapie (CBT) für eine evidenzbasierte Behandlung. Die Menopause wird hier als diagnostisches Fenster begriffen, um Gesundheitsdaten zur aktiven Prävention von altersbedingten Folgekrankheiten (wie Osteoporose) zu nutzen. Dieser konsequente Ansatz überzeugte auch den Schweizer Company Builder Maximon, der diese Brücke zur Langlebigkeit (Longevity) mit einem Seed-Investment von 2,5 Millionen Euro untermauerte.

Vyld (Gründung: 2021)

Ines Schiller und Melanie Schichan transformieren mit Vyld die Monatshygiene durch marine Biotechnologie. Das Start-up bietet sogenannte Kelpons aus Meeresalgen an. Dieser Rohstoff ist nicht nur radikal nachhaltig, sondern liefert einen massiven medizinischen USP: Algen sind von Natur aus hypoallergen, extrem saugfähig und kommen ohne schädliche Bleichmittel oder PFAS (Ewigkeitschemikalien) aus, was das empfindliche vaginale Mikrobiom aktiv schützt. Radikal ist bei Vyld auch die Struktur: Das Start-up agiert im Verantwortungseigentum (Steward-Ownership), wodurch Unternehmenszweck und Sicherheit stets vor kurzfristiger Gewinnmaximierung der Gesellschafter stehen. Dass dieser ethische DeepTech-Ansatz massiv skalieren kann, beweist die Finanzierung: Neben Impact-Investoren wie The Case for Her und millionenschweren Crowdinvesting-Instrumenten wird die Materialforschung von Vyld durch signifikante Fördermittel des Bundesministeriums für Bildung und Forschung (BMBF) validiert.

theblood (Gründung: 2022)

Das Gründerinnen-Duo Isabelle Guenou und Miriam Santer nutzt Menstruationsblut als diagnostische Goldmine. Ihr Geschäftsmodell basiert auf einer innovativen, nicht-invasiven Analyseplattform, die das lange tabuisierte Menstruationsblut nutzt, um ein breites Spektrum an Biomarkern – von Sexualhormonen bis hin zu essenziellen Nährstoffen wie Ferritin (Eisen) – zu tracken. Ein natürliches, zyklisches Abfallprodukt wird so zum hochwertigen Datensatz für die präventive Gesundheitsvorsorge, ganz ohne Nadelstich beim Arzt. Wie resilient und marktreif das Duo agiert, bewies es nach einem medienwirksam geplatzten TV-Investment („Die Höhle der Löwen“): theblood ließ sich nicht beirren und holte stattdessen hochkarätige strategische Partner an Bord. Dass dieser Ansatz massives Vertrauen genießt, zeigt die heutige Riege der Geldgeber: Neben Roosh Ventures und RoX Health investierte unter anderem Klosterfrau Ventures strategisch in die Berliner Pionierarbeit.

Internationaler Ausblick & Fazit

Der Blick über die deutschen Grenzen zeigt 2026 klar, in welche Richtung der Kompass navigiert. Aus den USA schwappt eine massive Welle der KI-basierten Wirkstoffentdeckung speziell für gynäkologische Erkrankungen nach Europa, während Asien die Hardware-Miniaturisierung für kontinuierliches Hormon-Tracking vorantreibt. Ein entscheidender globaler Makro-Trend ist jedoch die Souveränität der Intimdaten. In einer volatilen regulatorischen Ära in den USA (Post-Roe-v.-Wade) hat sich die europäische DSGVO vom Standortnachteil zum ultimativen Wettbewerbsvorteil entwickelt. Internationale Nutzerinnen suchen zunehmend Schutz bei europäischen Plattformen, die strikte Datensicherheit garantieren. Dies eröffnet deutschen Start-ups ungeahnte Exportchancen als absolute Vertrauensführer.

Für Gründer*innen und Investor*innen bedeutet dies: Die Zeit der reinen Wellness-Gadgets ist endgültig vorbei. Wer 2026 erfolgreich sein will, muss die Gender Data Gap schließen, klinische Evidenz liefern und den Datenschutz als ethisches Fundament begreifen. FemTech ist kein Nischen-Portfolio-Baustein mehr für die Diversity-Quote, sondern der am stärksten unterbewertete Treiber für die Zukunft der gesamten Gesundheitsökonomie. Wer heute in Gender-Medizin investiert, investiert in die Qualität der Medizin von morgen.

ODONATAs Sprung zur Multi-Mission-Drohne

Vom scheiternden Lufttaxi-Traum zum taktischen Technologieträger: Das Münchner Start-up ODONATA hat mit dem PANTALA-Hovertest einen entscheidenden Pivot eingeleitet. Am 10. April 2026 erreichte das Unternehmen auf dem Militärflughafen der Bundeswehr im fränkischen Roth einen Meilenstein und absolvierte den ersten Schwebeflug des 1:1-Prototyps seiner Langstreckendrohne. Doch hinter der Erfolgsmeldung steckt eine tiefgreifende strategische Neuausrichtung des 2021 von Dennis Furchheim, Tobias Nickel und Dominik Weigl gegründeten Unternehmens. Wir haben uns mit Co-Founder Dennis Furchheim darüber ausgetauscht.

Gegründet im Jahr 2021 im Rahmen des ESA-Business-Incubation-Programms, verfolgten die ODONATA-Gründer Dennis Furchheim, Tobias Nickel und Dominik Weigl ursprünglich eine weitaus kapitalintensivere Vision: ein bemanntes, wasserstoffbasiertes Flugtaxi (eVTOL). Doch die Realität der Finanzmärkte zwang das Team zum Umdenken. „Die Finanzierung eines solchen Vorhabens ist grundsätzlich schon nicht einfach“, erinnert sich CEO Dennis Furchheim an die kritischen Phasen der letzten fünf Jahre.

Besonders die Probleme anderer Branchengrößen belasteten das junge Unternehmen: „Wenn aber die Entwicklungen, wie beispielsweise bei Lilium, einen in Sippenhaft nehmen, weil nicht unterschieden wird zwischen verschiedenen Konzepten, dann wird es noch härter.“ In dieser Situation habe der „Zeitenwechsel“ und der neue Fokus auf Dual-Use den nötigen Befreiungsschlag ermöglicht.

Mitte 2024 folgte der scharfe Kurswechsel weg vom zertifizierungsrechtlich komplexen Passagiermarkt. Furchheim räumt offen ein, dass dies auch eine Reaktion auf den Standort Deutschland war: „Wir haben ursprünglich mit dem Ziel gestartet, ein eVTOL für Passagiere zu entwickeln und zu produzieren. Wir haben allerdings lernen müssen, dass Investoren in Deutschland nicht in so langfristig angelegte Projekte investieren.“

Der Schwenk zur autonomen Drohne PANTALA sei zwar „hart“ gewesen, doch das Team konnte wertvolle Erfahrungen und Technologien aus der ersten Phase transferieren.

PANTALA: Technik mit Schwerpunkt-Trick

Die nun getestete PANTALA-Drohne ist als Multi-Mission-Plattform konzipiert, die Logistik, Lagebildgewinnung und Drohnenabwehr vereint. Mit einer Spannweite von 7,9 Metern und einem maximalen Startgewicht von 280 Kilogramm kann sie bis zu 80 Kilogramm Nutzlast transportieren. Dank einer hybriden Antriebsarchitektur – batterieelektrisch für Start und Landung, ein Kraftstoffsystem für den Reiseflug – soll sie über zehn Stunden in der Luft bleiben und eine Reichweite von mehr als 1.100 Kilometern erzielen.

Ein technologisches Highlight ist der zum Patent angemeldete verschiebbare Antriebsstrang, der die Schwerpunktsanpassung im Flug bei variierenden Lasten ermöglicht. Angesprochen auf die Zukunftsfähigkeit des Antriebs gibt sich der Gründer pragmatisch. „Wir haben uns bewusst technologieoffen aufgestellt“, betont Furchheim im Hinblick auf die noch fehlende Wasserstoff-Infrastruktur. Er verspricht: „So können wir mit klassischen Treibstoffen, elektrisch und künftig auch mit Wasserstoff fliegen, je nachdem, wie die Infrastruktur sich entwickelt.“

Der Marktdruck und die Konkurrenz

Obwohl ODONATA durch Partner wie die ESA und die TUM Venture Labs Aerospace unterstützt wird, bleibt der Kapitalbedarf massiv. Im Wettbewerb mit bereits etablierten Playern wie Quantum Systems muss sich das Start-up behaupten. Furchheim sieht sein Unternehmen jedoch technologisch im Vorteil.

„Wir haben zwei zentrale Vorteile“, erklärt der CEO selbstbewusst: „Zum einen haben wir eine höhere Payload mit bis zu achtzig Kilogramm, was uns ermöglicht, ganz neue Use-Cases zu bedienen.“ Zudem ermögliche die enorme Reichweite eine Überwachung von Frontabschnitten oder kritischer Infrastruktur über viele Stunden hinweg. Laut Furchheim gibt es bereits konkrete Gespräche mit Interessenten, „die genau auf so etwas warten“.

Zwischen Ethik und Skalierung

Die Ausrichtung auf den Sicherheitssektor bringt neben internationalem Interesse aus den USA, Indien oder der Ukraine auch strikte Rüstungsexportkontrollen mit sich. Auf die Frage nach den regulatorischen Hürden beim Export von Dual-Use-Gütern reagiert der Gründer zurückhaltend, deutet aber eine enge Abstimmung mit nationalen Stellen an. „Ohne zu viel zu verraten, wir sind im Gespräch mit der Bundeswehr, damit wir unser System auf diese Anforderungen hin optimieren“, erklärt Furchheim, räumt jedoch ein: „Aber es ist natürlich eine Hürde, die es nicht leichter macht.“

Der erfolgreiche Hovering-Test markiert den bisher wichtigsten Fortschritt. Der nächste entscheidende Lackmustest für ODONATA wird nun der aerodynamisch anspruchsvolle Übergang in den Reiseflug sein. Nur wenn dieser nahtlos gelingt, wird das System die wachsende internationale Nachfrage tatsächlich bedienen können.

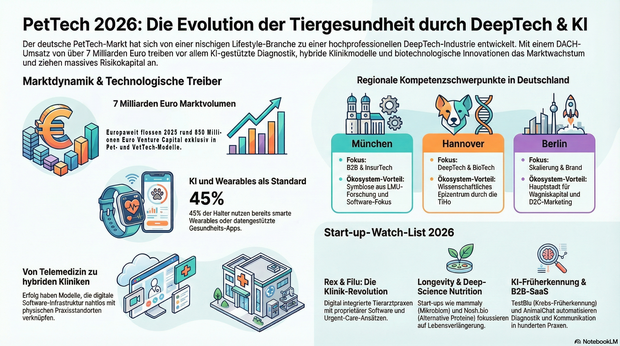

PetTech-Start-up-Report 2026

Wie DeepTech und KI den aktuellen PetTech-Markt prägen und welche Start-ups das Segment hierzulande dominieren. Plus: Die exklusive Start-up-Watch-List.

In den vernetzten De-Novo-Kliniken Berlins und Münchens scannen KI-Algorithmen heute in Millisekunden die MRT-Bilder von Haustieren, während personalisierte Longevity-Supplemente vollautomatisch an das Smart-Home der Halter geliefert werden. Der Vierbeiner des Jahres 2026 ist ein Premium-Patient und voll integrierter digitaler Lifestyle-Avatar, der eine hochkomplexe Gesundheitsökonomie antreibt. Venture-Capital-Fonds analysieren mittlerweile die Auslastungsquoten tierärztlicher Computertomographen genauso akribisch wie die wiederkehrenden Software-Umsätze im B2B-Sektor.

Wir blicken auf eine knallhart professionalisierte Industrie, in der radikale Effizienz und DeepTech den Takt angeben. Es geht um Algorithmen-gestützte Frühdiagnostik, hochskalierbare Praxis-Infrastrukturen und biotechnologische Nahrung – eine Ära, in der pure Tierliebe direkt auf tiefgreifende wissenschaftliche Innovation trifft und Investitionen in Milliardenhöhe rechtfertigt.

Ein hochreifer Milliardenmarkt unter KI-Einfluss

Der deutsche Markt für Heimtiere hat einen beispiellosen Reifegrad erreicht. Mit weit über 34 Millionen Haustieren allein in der Bundesrepublik sprechen wir von einem adressierbaren Markt, der längst nicht mehr nur Premium-Futter, sondern zunehmend hochpreisige Gesundheits- und Tech-Dienstleistungen konsumiert. Der technologische Haupttreiber im Jahr 2026 ist zweifelsohne die künstliche Intelligenz, dicht gefolgt von tiefen Integrationen des Internets der Dinge im Alltag der Tiere.

Laut einer aktuellen Bitkom-Studie nutzen mittlerweile über 45 Prozent der Halter*innen in Deutschland smarte Wearables oder datengestützte Gesundheits-Apps für ihre Tiere. Das spiegelt sich auch in den Bilanzen wider: Der Branchenumsatz im DACH-Raum hat die 7-Milliarden-Euro-Marke signifikant überschritten. Dabei flossen laut jüngsten Auswertungen von KfW Research im vergangenen Jahr europaweit rund 850 Millionen Euro Venture Capital exklusiv in Pet- und VetTech-Modelle.

Die neuen Treiber: Kliniken, Longevity und SaaS-Infrastruktur

Aktuell dominieren im PetTech-Sektor drei hochspezifische Sub-Sektoren den Markt. Allen voran steht der Bereich der De-Novo Vet-Tech-Kliniken. Hier verschmelzen physische Tierarztpraxen mit einer proprietären, durchdigitalisierten Software-Infrastruktur, die von der Terminbuchung bis zur KI-gestützten Diagnostik reicht. Etablierte Pioniere wie das Berliner Start-up Rex haben den Weg für diese hybriden Modelle geebnet.

Ein weiterer massiver Treiber ist die Pet-Longevity in Kombination mit DeepTech-Nutrition. Hier geht es nicht mehr um getreidefreies Futter, sondern um mikrobiom-basierte Nahrungsergänzungen und Alternative Proteine aus dem Bioreaktor, die das Leben der Tiere nachweislich verlängern sollen.

Der dritte dominierende Sektor ist B2B-Vet-SaaS. Start-ups bauen spezialisierte Software für Tierärzte, die Bilderkennung für Scans automatisiert und dem chronischen Fachkräftemangel in den Praxen entgegenwirkt.

Die geplatzten Träume der Solo-Telemedizin

Doch der Weg in dieses reife Marktumfeld war gepflastert mit schmerzhaften Lektionen. Der prominenteste Crash der jüngeren Vergangenheit war die spektakuläre Insolvenzwelle im Bereich der reinen Pet-InsurTechs und Solo-Telemedizin-Plattformen um das Jahr 2023 und 2024. Ein Paradebeispiel war das Berliner Neo-Versicherungs-Start-up Coya, das sich stark auf Tierversicherungen fokussiert hatte, vom französischen Konkurrenten Luko geschluckt wurde und letztlich in einem Insolvenzverfahren endete. Gleichzeitig verbrannten reine Tele-Vet-Apps, die ohne eigene physische Kliniken operierten, Millionen an VC-Geldern.

Aus diesen Debakeln lassen sich vier konkrete, fatale Fallstricke für heutige Gründer ableiten. Erstens die tödliche B2C-Kund*innenakquisitions-Falle: Wer heute im Pet-Bereich rein auf Performance-Marketing in sozialen Netzwerken setzt, wird von den astronomischen Customer Acquisition Costs erdrückt. Zweitens die Ignoranz gegenüber der Regulatorik, insbesondere der Gebührenordnung für Tierärzte. Der Gebührenschock der vergangenen Jahre brach Geschäftsmodellen das Genick, die diese Preissteigerungen nicht einkalkuliert hatten. Drittens das Dogma, dass Technologie den persönlichen Kontakt ersetzen kann: Haustiere können nicht ausschließlich über einen Bildschirm behandelt werden; wer keine physischen Anlaufstellen hat, scheitert an der Realität der Tiermedizin. Viertens die Vernachlässigung der Unit Economics zugunsten eines ungesunden Wachstums, was in einem Markt mit starker lokaler Bindung unweigerlich zum Cashflow-Kollaps führt.

Das deutsche PetTech-Netzwerk

Die deutsche PetTech-Landschaft hat sich auf wenige, aber extrem leistungsstarke Hubs konzentriert. München führt diese Liste unangefochten an. Mit der Ludwig-Maximilians-Universität, die eine der weltweit angesehensten tierärztlichen Fakultäten beheimatet, und dem InsurTech Hub Munich entsteht hier die perfekte Symbiose aus medizinischer Forschung und starkem B2B-Software-Fokus. Hannover verteidigt seinen Status als wissenschaftliches Epizentrum durch die Stiftung Tierärztliche Hochschule Hannover. Aus dem Umfeld dieser Elite-Forschungseinrichtung entspringen derzeit die tiefgreifendsten DeepTech- und BioTech-Ausgründungen der Branche. Berlin hingegen bleibt die unangefochtene Hauptstadt für Skalierung, Wagniskapital und D2C-Brandbuilding. Hier sitzen die großen Geldgeber*innen und Marketing-Genies, gestützt durch lokale Netzwerke. Leipzig komplettiert das Quartett als aufstrebender Star: Die Kombination aus der Veterinärmedizinischen Fakultät der Universität Leipzig und der BioCity, einem exzellenten Cluster für Biotechnologie, zieht zunehmend Start-ups an, die an der Schnittstelle von Tiergesundheit und Zellbiologie arbeiten.

Investor*innen-Radar

Das Kapital fließt heute intelligenter und zielgerichteter. Bei den spezialisierten VCs dominieren Fonds wie Five Seasons Ventures, die tiefes Verständnis für die Schnittstelle von FoodTech und Pet-Nutrition mitbringen, sowie global agierende Vehikel wie der Companion Fund. Im Bereich der Top-Tier Generalisten haben europäische Schwergewichte wie Cherry Ventures, Vorwerk Ventures und DN Capital den Sektor für sich entdeckt und pumpen beträchtliche Summen in hybride Klinik-Modelle und B2B-SaaS. Ein wesentlicher Machtfaktor sind mittlerweile die Corporate VCs der Industrie. Fressnapf dominiert mit seiner Beteiligungsgesellschaft die Früh- und Wachstumsphase strategisch, während Mars Petcare über seinen Arm Kinship massiv nach Europa drängt.

Der eigentliche Motor der Innovation liegt jedoch bei den Frühphasen-Motoren und Business Angels. Hier brillieren Köpfe wie Lukas Keindl, der als Gründer des US-Vorbilds Bond Vet nun aktiv sein Know-how und Kapital in die europäische Gründerszene pumpt, sowie spezialisierte Angel-Syndikate und Netzwerke wie der Auxxo Female Catalyst Fund, die gezielt diverse Gründungsteams in der Tiermedizin fördern.

Die Top-PetTech-Start-ups (Must-Watch)

Die nachfolgende Auswahl der Top Start-ups basiert auf einer strengen redaktionellen Analyse. Die zentralen Kriterien für die Aufnahme in dieses Ranking sind eine nachgewiesene Marktrelevanz durch messbares Praxis- oder Nutzerwachstum, ein hoher technologischer Reifegrad fernab reiner Konzeptphasen sowie das ausdrückliche Vertrauen namhafter Lead-Investoren. Um die aktuelle Innovationskraft des deutschen Ökosystems abzubilden, haben wir uns ausschließlich auf deutsche Start-ups konzentriert, deren Gründung im Jahr 2020 oder später erfolgte. Die Liste beleuchtet bewusst eine Diversität an Geschäftsmodellen, von B2B-Software über BioTech bis hin zu hybriden Versorgungskonzepten.

Rex

Das im Jahr 2021 von Julian Lechner und Jonathan Loesing gegründete Berliner Start-up Rex ist das aktuelle Paradebeispiel für moderne Tiermedizin. Rex kombiniert ein B2B/B2C-Hybrid-Modell und baut architektonisch anspruchsvolle, digital voll integrierte T Tierärzt*innenpraxen auf. Der USP liegt in der proprietären Praxismanagement-Software, die den Tierärzt*innen die Administration abnimmt, und der nahtlosen App-Experience für den Tierhalter. Das enorme Potenzial dieses Modells überzeugte Vorwerk Ventures, Picus Capital und weitere namhafte Investor*innen, die dem Unternehmen bereits zweistellige Millionenbeträge anvertrauten.

Filu

Ebenfalls angetreten, um den chronisch überlasteten Tierärzt*innenmarkt zu revolutionieren, ist das Münchner Start-up Filu. Gegründet 2022 von Anna Magdalena Naderer, Christian Köhler und Justus Buchen, positioniert sich das Unternehmen mit seinem Urgent-Care-Ansatz gekonnt zwischen klassischer Allgemeinpraxis und Notfallklinik. Die Kombination aus modernster Hardware vor Ort und smarten Tele-Triage-Prozessen im Hintergrund sorgt für eine extrem hohe Effizienz. Lead-Investoren wie DN Capital und YZR Capital haben das immense Skalierungspotenzial früh erkannt und die Expansionspläne befeuert.

mammaly

Im Bereich der D2C-Tiergesundheit setzt das 2020 in Köln von Stanislav Nazarenus und Alexander Thelen gegründete Start-up mammaly neue Standards. Das Geschäftsmodell basiert auf dem Direktvertrieb von hochwirksamen, mit Tierärzt*innen entwickelten Nahrungsergänzungsmitteln in Snackform. Der USP liegt in der tiefgreifenden Fokussierung auf das Mikrobiom von Hunden, um altersbedingte Beschwerden proaktiv zu lindern. Dieses datengetriebene und markenstarke Konzept sicherte mammaly unter anderem ein substanzielles Funding durch den spezialisierten VC Five Seasons Ventures.

PetLEO

Dieses 2020 in München von Karim Abdo und Bülent Hacioglu gegründete Unternehmen agiert als eine hochkomplexe B2B2C-Gesundheitsplattform. PetLEO verbindet Tierärzt*innen, Expert*innen und Haustierbesitzer*innen in einem geschlossenen, digitalen Ökosystem. Tierhalter*innen können Gesundheitsdaten verwalten, Giftköder-Warnungen erhalten und Termine buchen, während die Praxen selbst eine moderne Schnittstelle zur Kund*innenbindung erhalten. Das Start-up hat sich durch starke Partnerschaften mit Industrie und Versicherungen eine äußerst wehrhafte Marktposition als digitaler Alltagsbegleiter erarbeitet.

Hundeo

Dass man auch ohne massive externe Kapitalrunden im PetTech-Markt dominieren kann, beweist das 2020 von Enrico Bachmann in Berlin gegründete Start-up Hundeo. Das B2C-EdTech-Modell ist eine gamifizierte App für modernes Hundetraining. Der technologische USP ist die personalisierte, KI-gestützte Trainingsplanung, die sich dem Lernfortschritt des jeweiligen Tieres anpasst. Mit enormem organischem Wachstum und starker Nutzer*innenbindung gehört das gebootstrappte Hundeo zu den profitablen Vorzeige-Start-ups der App-Economy.

Nosh.bio

Obwohl nicht exklusiv für den Pet-Markt gegründet, rüttelt das 2022 von Tim Fronzek und Felipe Lino in Berlin ins Leben gerufene DeepTech-Start-up Nosh.bio die Tiernahrungsindustrie fundamental auf. Das B2B-Geschäftsmodell fokussiert sich auf die Herstellung von Alternativen Proteinen aus Pilzmyzel. Der technologische USP liegt in einem hocheffizienten Fermentationsprozess, der saubere, hochverdauliche und texturstarke Proteinquellen aus Pilzmyzel liefert. Als hochfunktionale „Clean-Label“-Zutat ermöglicht sie die Entwicklung erstklassiger, fleischfreier Tiernahrung – völlig ohne chemische Zusätze und ohne den massiven ökologischen Fußabdruck der konventionellen Fleischindustrie. Lead-Investor Earlybird unterstützt dieses zukunftsweisende BioTech-Modell.

TestBlu

Mit Gründung im Jahr 2022 in Potsdam bringt TestBlu echte Deep-Science in die tierärztliche Praxis. Das von Shahab Shoaei Matin geführte Geschäftsmodell ist ein KI-gestütztes B2B-SaaS-Produkt für Veterinärkliniken. Der USP des Unternehmens ist Deutschlands erster Bluttest zur Früherkennung von Krebs bei Hunden. Ein hochkomplexer Algorithmus analysiert Blutbilder auf Anomalien mit enormer Präzision. TestBlu positioniert sich als unverzichtbarer onkologischer Co-Pilot für Tierärzt*innen, um die diagnostische Sicherheit drastisch zu erhöhen.

AnimalChat

Die 2020 von Sebastian Wilkes und dem erfahrenen Tierarzt Dr. Heinrich Wilkes aus Borken gestartete B2B-Software AnimalChat hat das Problem der ineffizienten Kommunikation in Praxen radikal gelöst. Das Start-up bietet einen DSGVO-konformen, professionellen Messenger-Dienst speziell für Veterinär*innen und deren Klient*innen an. Der USP ist die nahtlose Integration von asynchroner Kommunikation und digitaler Wundverlaufskontrolle, ohne dass der Arzt bzw. die Tierärztin seine bestehende Praxissoftware austauschen muss. Dieses pragmatische, aber hochskalierbare Tool hat sich in hunderten Praxen als Standard etabliert.

Internationaler Ausblick & Fazit

Wer heute verstehen will, was morgen in Europa passiert, muss den Blick zwingend über den Tellerrand richten. Drei globale Makro-Trends werden den deutschen PetTech-Markt in Kürze massiv umwälzen. Aus den USA schwappt die Welle der Longevity-Pillen herüber, wo Start-ups bereits erste FDA-Zulassungen für Medikamente anstreben, die das biologische Altern von Hunden verlangsamen. Asien hingegen definiert den Standard für Hyper-Vernetzung neu: Hier sind smarte Katzentoiletten und vollautomatische, mit dem Smart-Home synchronisierte Futterautomaten, die Gesundheitsdaten in Echtzeit an den Tierarzt bzw. die -ärztin senden, bereits Massenmarkt. In Israel, dem weltweiten Hub für FoodTech, verschmilzt derweil AgriTech mit Tiernahrung. Kultiviertes Fleisch aus dem Labor für Premium-Tiernahrung steht dort nach der ersten regulatorischen Marktzulassung für Heimtierfutter in Großbritannien durch das Start-up Meatly endgültig vor dem globalen Durchbruch.

Das Fazit für 2026 ist eindeutig: Der Welpenschutz für Gründer*innen ist abgelaufen. PetTech ist ein knallhartes Business, das exzellente Unit Economics, tiefes regulatorisches Verständnis und echte technologische Alleinstellungsmerkmale verlangt. Investor*innen suchen heute nach Geschäftsmodellen, die reale Engpässe wie den Tierärzt*innenmangel lösen oder die Lebensspanne der Tiere durch harte Wissenschaft verlängern. Wer in diesem 20-Milliarden-Markt mitspielen will, muss beweisen, dass er/sie nicht nur Tiere liebt, sondern vor allem sein/ihr strategisches und technologisches Handwerk versteht.

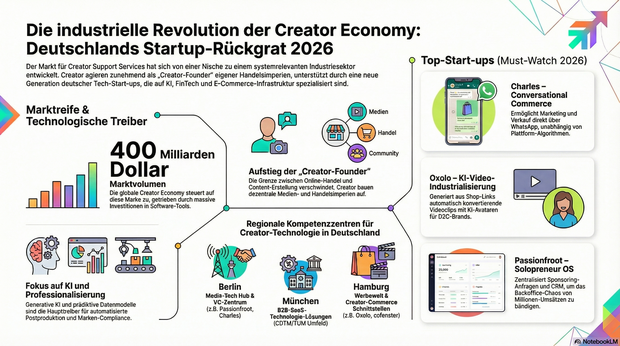

Start-up-Report: Creator Support Services

Die industrielle Revolution der Creator*innen ist in vollem Gange: Unser Report beleuchtet den boomenden Markt und zeigt die deutschen Tech-Start-ups, die das Rückgrat der neuen Medien-Champions bauen.

Wir erleben das Entstehen einer neuen ökonomischen Spezies: Der Creator-Founder. Die Grenze zwischen dem/der klassischen Online-Händler*in und dem/der modernen Content-Creator*in ist endgültig gefallen. Wer heute Reichweite besitzt, baut keine Community mehr auf, sondern ein dezentrales Medien- und Handelsimperium. Diese Transformation vom Nischenthema zur Systemrelevanz braucht jedoch eine industrielle Basis. Genau hier betritt eine neue Generation von Start-ups die Bühne. Diese „Werkzeugmacher*innen“ – spezialisiert auf KI-gesteuerte Produktion, autonome Analyse und FinTech – bilden das unsichtbare, hochprofitable Rückgrat einer Branche, die gerade ihre industrielle Revolution erlebt.

Das Ökosystem wird erwachsen

Die Marktlage im Jahr 2026 beweist eindrucksvoll, dass die Werkzeug-Infrastruktur für digitale Entrepreneur*innen den Kinderschuhen entwachsen ist. Laut aktuellen Hochrechnungen etablierter Investmentbanken steuert die globale Creator Economy unaufhaltsam auf die 400-Milliarden-Dollar-Marke zu, wobei ein signifikanter zweistelliger Prozentsatz direkt in Software- und Servicetools fließt.

Auch in Deutschland bestätigt der jüngste KfW-Gründungsmonitor diese Reife: Software-Lösungen für digitale Medienschaffende gehören zu den widerstandsfähigsten B2B-Segmenten der Post-Krisen-Ära. Der technologische Haupttreiber dieser rasanten Professionalisierung ist zweifellos die angewandte generative künstliche Intelligenz, dicht gefolgt von prädiktiven Datenmodellen. Deutsche Risikokapitalgeber*innen haben im vergangenen Jahr schätzungsweise über 350 Millionen Euro spezifisch in dieses Vertical gepumpt. Es geht längst nicht mehr um experimentelles Wagniskapital, sondern um Growth-Metriken und wiederkehrende SaaS-Umsätze in einem Markt, der eine beispiellose Professionalisierung erfährt.

Technologien der totalen Integration

Blickt man jenseits der offensichtlichen Dashboards, offenbaren sich die wahren Maschinenräume dieses Jahres. Drei Sub-Sektoren dominieren aktuell das Geschehen und treiben die Verschmelzung von Commerce und Content voran. Zunächst ist da die autonome KI-Postproduktion, bei der Algorithmen nicht nur schneiden, sondern selbständig Narrative für Verkaufsformate generieren.

Ein weiterer massiver Treiber ist die prädiktive Marken-Compliance. Hierbei handelt es sich um Legal-Tech-Lösungen, die vollautomatisiert Werbekennzeichnungspflichten und internationale Steuermodelle für Creator-Marken überwachen.

Schließlich etabliert sich das Creator FinTech, insbesondere durch umsatzbasierte Finanzierungsmodelle, die den dynamischen Cashflow von Influencer-Brands algorithmisch bewerten können. Während Pioniere der ersten Welle wie Linktree lediglich Brücken bauten, stoßen die aktuellen Akteure tief in diese hochkomplexen, technologischen Nischen vor, um den Creator*innen als vollwertigen E-Commerce-Akteur*innen zu befähigen.

Reality Check: Der Kater nach dem Hype

Dass diese Branche jedoch kein automatischer Garant für Einhörner ist, bewies der spektakuläre Crash der Web3-Creator-Plattformen um das Jahr 2023. Hochgelobte Projekte wie BitClout verbrannten Hunderte Millionen Dollar an Risikokapital, weil sie die Usability vernachlässigten und keinen echten Nutzwert jenseits der Spekulation boten. Aus diesem schmerzhaften Reality Check lassen sich vier fatale Fallstricke für heutige Gründer*innen ableiten. Der erste Fehler ist das API-Klumpenrisiko, also die blinde Abhängigkeit von den Launen großer Plattformen wie Meta oder YouTube. Ein zweites, oft tödliches Problem sind katastrophale Unit Economics bei Tools, die nur den nicht-monetarisierbaren "Long Tail" der Hobby-Nutzer*innen bedienen. Der dritte Fallstrick ist die chronische Unterschätzung der Regulatorik, insbesondere des EU AI Acts. Das vierte Learning betrifft den Technologie-Fetischismus: Wer Lösungen aufzwingt, die technologisch brillieren, aber in der alltäglichen User Experience der Creator*innen versagen, wird vom Markt gnadenlos abgestraft.

Deutschlands heimliche Creator-Hubs

Die architektonische Landkarte der deutschen Creator-Tool-Landschaft konzentriert sich 2026 auf hochspezialisierte Hotspots. Berlin bleibt der unangefochtene Magnet, angetrieben von einer dichten Konzentration an Media-Tech-VCs und der Strahlkraft von Kaderschmieden wie der ESMT. München agiert als das kraftvolle Gegenstück für harte Technologiebedingungen. Angefacht durch das CDTM und die TU München, entstehen hier vor allem datenlastige B2B-SaaS-Produkte für die Industrie. Das Rheinland, spezifisch die Achse Aachen und Köln, fungiert als historisch gewachsenes Cluster, das auf dem Fundament klassischer TV-Produktionen und starken Informatik-Fakultäten wie der RWTH Aachen basiert. Abgerundet wird dieses Netzwerk durch Hamburg. Die Hansestadt nutzt ihre tiefe Verwurzelung in der Werbe- und Agenturwelt sowie Netzwerke wie den Next Media Accelerator, um Tools zu entwickeln, die genau an der Schnittstelle zwischen Markenbudgets und der Creator-Commerce-Welt ansetzen.

Investor*innen-Radar