Aktuelle Events

Top KI-Prompts für Start-ups

Diese Prompts liefern dir konkrete Handlungsanweisungen, wie du den Mehrwert von KI voll ausschöpfen kannst.

Künstliche Intelligenz (KI) hat sich als mächtiges Werkzeug erwiesen, das dir dabei dabei hilft, deine Effizienz zu steigern, innovative Lösungen zu entwickeln und Marktchancen zu nutzen. Doch der Einstieg in KI kann regelrecht erschlagend sein – von der Auswahl der richtigen Anwendungen bis hin zur Implementierung in den Betriebsablauf gibt es viele Hürden zu überwinden.

Genau hier kommen KI-Prompts ins Spiel: strukturierte Ideen und Anregungen, die dir helfen, den Einsatz von KI zu optimieren. Dieser Artikel bietet einen Überblick über die besten KI-Prompts für Start-ups.

1. KI-Prompts für die Content-Erstellung

Egal ob bei der Findung von Themenideen oder der Erstellung ganzer Texte, mit dem richtigen Briefing kann KI ein richtiger Gamechanger sein:

Schreibblockade überwinden

„Wecke deine Kreativität und generiere frische Ideen für einen Blogbeitrag zum Thema <Thema>. Entwickle eine Struktur aus zehn Punkten für den Beitrag und schlage fünf fesselnde Überschriften vor, die dein Publikum begeistern werden.“

Überschriften und Schlagzeilen generieren

„Nutze die Kreativität eines erfahrenen Content-Marketers, um 25 überzeugende Ideen für Überschriften zu <Thema> zu entwickeln, die bei der Zielgruppe für die <Branche>-Branche Anklang finden. Jeder Titel sollte einzigartig sein, relevante Keywords für die Suchmaschinenoptimierung enthalten und die Kernaussage des jeweiligen Inhalts auf den Punkt bringen. Der Ton und die Stimme der Marke sollten <Adjektiv> sein. Das Zielpublikum ist <Zielgruppe>. Denke daran, Neugierde zu wecken und das Engagement zu fördern.“

Produktbeschreibungen verfassen

„Schlüpfe in die Rolle eines Produkttexters und verfasse eine fesselnde und ansprechenden Produktbeschreibung, die die <Zielgruppe> überzeugt. Die Beschreibung sollte die Merkmale, Vorteile und Alleinstellungsmerkmale der Produkte hervorheben, um Kaufentscheidungen zu beeinflussen und den Verkauf zu fördern. Die Produkte sind: <Produkte>.“

2. KI-Prompts für Social Media

In einer zunehmend vielfältigen Social-Media-Landschaft mit verschiedenen Plattformen und Post-Formaten kann die Content-Erstellung zur echten Herausforderung werden. Folgende Prompts können dich und dein Team dabei unterstützen bzw. entlasten:

Social-Media-Posts verfassen

„Verkörpere die Rolle eines erfahrenen Werbetexters und nenne Richtlinien für das Verfassen von fesselnden Social-Media-Captions. Vermittle Techniken zur Erstellung Aufmerksamkeit gewinnender Aufhänger, Storytelling-Elemente und Handlungsaufforderungen für mein Unternehmen <Unternehmen> in <Branche>. Biete Ratschläge für die Anpassung von Bildunterschriften an bestimmte Plattformen und Publikumsvorlieben. Befähige mich als Unternehmer, überzeugende Bildunterschriften zu erstellen, die das Engagement erhöhen und zu den gewünschten Handlungen führen. Gib dann fünf Beispiele in einem <Ton> Ton an.“

Zielgruppe vergrößern, Interaktion steigern

„Fungiere als einflussreicher Community-Manager und skizziere Strategien, um das Social-Media-Publikum von <Unternehmen> zu vergrößern und zu binden. Biete Techniken zur Steigerung der Follower, Optimierung von Profilen und effektiver Verwendung von Hashtags an. Gib Ratschläge zur Förderung von Engagement durch interaktive Beiträge, Wettbewerbe und nutzergenerierte Inhalte. Hilf dem Unternehmer dabei, Beziehungen zu seinem Publikum aufzubauen, indem er auf Kommentare, Nachrichten und Bewertungen antwortet. Ermächtige den Unternehmer dazu, eine Social-Media-Community aufzubauen und Markenloyalität zu fördern.“

Kund*innenservice via Social Media optimieren

„Agiere als Experte für den Kundenservice in den sozialen Medien und stelle Richtlinien für einen herausragenden Kundenservice über soziale Medienkanäle für mein Unternehmen <Unternehmen> in <Branche> bereit. Skizziere Strategien für die Beantwortung von Anfragen, das Eingehen auf Kundenanliegen und die Lösung von Problemen. Gib Ratschläge, wie man einen positiven und professionellen Ton beibehält, Antworten personalisiert und Unterhaltungen bei Bedarf auf private Kanäle verlagern kann. Befähige Unternehmer dazu, einen erstklassigen Kundenservice in den sozialen Medien zu bieten und so die Kundenzufriedenheit und Treue zu erhöhen.“

3. KI-Prompts für SEO

Suchmaschinenoptimierung (SEO) ist ein entscheidender Faktor, in der Praxis aber oft komplex. Diese KI-Prompts vereinfachen den Prozess deutlich:

SEO-Keywords generieren

„Generiere eine vielfältige Liste hocheffektiver SEO-Keywords für <Unternehmen> in der <Branche>, Standort: <Stadt/Staat/Land oder online>. Nutze bewährte Keyword-Recherche-Tools und -Techniken, um relevante Keywords mit hohem Suchvolumen und geringem Wettbewerb zu ermitteln. Berücksichtige dabei Faktoren wie die Zielgruppe, Branchentrends und die spezifischen Angebote des Unternehmens. Erstelle eine Schlüsselwortliste, die primäre Schlüsselwörter, Long-Tail- Schlüsselwörter und standortbezogene Schlüsselwörter umfasst, um den Inhalt der Website zu optimieren und den organischen Traffic zu steigern.“

SEO-optimierte Blogartikel erstellen

„Handle als Experte für Online-Marketing. Du arbeitest für ein <Unternehmen> namens <Unternehmensname> in der Branche <Industrie>. Die Konkurrenten sind <Konkurrenten>. Schreibe eine Gliederung für einen Blogbeitrag unter Berücksichtigung der SEO. Das Thema des Blogbeitrags ist <Thema>, der Ton ist <Ton>, die Zielgruppe ist <Zielgruppe>. Konzentriere dich auf die Art und Weise, wie der Beitrag zeigen kann, dass sich das Unternehmen von seinen Konkurrenten unterscheidet. Beginne den Blogbeitrag mit einem interessanten Aufhänger. Jeder Teil der Gliederung sollte Folgendes enthalten: Name des Abschnitts; Überblick über den Inhalt des Abschnitts; welche Schlüsselwörter zur SEO in dem Abschnitt verwendet werden sollten; warum die ausgewählten Schlüsselwörter in diesem Abschnitt besser für die SEO sind als in einem anderen Abschnitt. Schreibe deine Antwort in Markdown. SEO-Schlüsselwörter: <SEO-Schlüsselwörter>.“

4. KI-Prompts für den Kund*innensupport

Eine erstklassige Kund*innenbetreuung ist von entscheidender Bedeutung für kleine Unternehmen. Diese KI-Prompts können hierbei unterstützen:

Kund*innenanfragen beantworten

„Handle wie ein Mitarbeiter im Kundenservice mit 20 Jahren Erfahrung in der Branche <Industrie>. Unterweise mich darin, wie ich eine taktvolle Antwort auf eine Kundenanfrage zu <Thema> formulieren kann. Stelle sicher, dass meine Antwort pünktlich, professionell, rücksichtsvoll und informativ ist und das Engagement des Unternehmens für die Kundenzufriedenheit unterstreicht. Zeige mir drei Beispiele unter Verwendung eines <Ton>-Tons.“

Negative Kund*innenrezension lösen

„Handle wie ein erfahrener Kundenbetreuer. Du arbeitest für ein <Unternehmen>. Verfasse eine rücksichtsvolle und lösungsorientierte Antwort an einen Kunden, der eine negative Bewertung über <Thema> abgegeben hat. Zeige dein Verständnis und dein Bedauern für die Unzufriedenheit des Kunden, versichere ihm, dass sein Anliegen ernst genommen wird, und biete eine geeignete Lösung für das Problem an. Zeige Einfühlungsvermögen und Professionalität.“

Tipp: Passe die Nutzung von KI-Prompts an deine individuellen Gegebenheiten an und formuliere Anfragen so präzise wie möglich. KI bietet eine Vielzahl von Einsatzmöglichkeiten, die über die genannten Beispiele hinausgehen. Experimentiere daher mit diesen Technologien und schöpfe ihr Potenzial voll aus. Wichtig: Bei der Verwendung von KI-Tools sollte die Eingabe sensibler Daten vermieden und die Ergebnisse stets auf ihre Richtigkeit hin überprüft werden.

Die Autorin Alexandra Anderson ist Marketing Director Germany bei GoDaddy und seit über zehn Jahren als Marketingexpertin in der IT-Branche tätig.

Diese Artikel könnten Sie auch interessieren:

„Wir scheitern nicht an der Technologie, sondern an der Kommerzialisierung“

Warum wandern Europas DeepTech-Gründer*innen ab? Wie viel Schuld trägt das europäische Ökosystem daran – und wie viel die Gründer*innen selbst? Im Interview: Dr. Martin Schilling, Ex-N26-COO und CEO von Deep Tech Momentum, über fehlendes Risikokapital, mangelnde Traktion und den schweren Weg zur Skalierung.

Deutschland und Europa sind starke Quellen für DeepTech-Innovationen – aus Universitäten, Forschungseinrichtungen, Patenten und technischer Domänenexpertise. Dass wir hier in der Spitzenliga spielen, belegen Studien wie das European Innovation Scoreboard, des Europäischen Patentamts und der Max-Planck-Gesellschaft regelmäßig. Dennoch stehen wir vor einem massiven Problem: Es mangelt nicht an Innovationen selbst, sondern an ihrer Kommerzialisierung. Im Vergleich zu den USA, wo Investor*innen häufig früher und mit höherer Risikobereitschaft auf große technologische Wetten setzen, finden europäische Start-ups zu spät Kund*innen, Traktion und risikofreudiges Kapital. Weil Kommerzialisierung, Industrialisierung und Wachstum hierzulande oft langsamer verlaufen, entsteht für viele Gründer*innen ein struktureller Druck, Kapital und Skalierung in den USA zu suchen.

Einer, der diese Lücke an der Schnittstelle von Gründer*innen, Kapital und Unternehmenskunden aus erster Hand beobachtet, ist Dr. Martin Schilling. Der ehemalige COO von N26 und Managing Director von Techstars Berlin ist heute Co-Founder und CEO von Deep Tech Momentum (DTM). DTM ist Europas führende Plattform für DeepTech und AI Innovation, findet vom 20. bis 21. Mai 2026 in Berlin statt und bringt Unternehmen als potenzielle Kund*innen, DeepTech-Start-ups als Anbieter*innen und Investor*innen aktiv zusammen.

Wir wollten von Martin Schilling erfahren: Wie viel Schuld trägt das europäische Ökosystem an der geschilderten Misere – und wie viel die Gründer*innen selbst?

StartingUp: Martin, du stellst die These auf, es mangele in Europa nicht an DeepTech-Innovationen, sondern an der Kommerzialisierung. Machen wir es uns damit nicht zu einfach? Müssten wir nicht ehrlicherweise auch über die katastrophal langsamen IP-Transfer-Prozesse an deutschen Universitäten, überregulierte Märkte und den Fachkräftemangel sprechen, die Start-ups schon abwürgen, bevor sie überhaupt etwas kommerzialisieren können?

Martin Schilling: Ich glaube, wir dürfen uns hier nichts vormachen. Natürlich haben wir in Europa strukturelle Probleme wie langsame IP-Transfer-Prozesse, fragmentierte Märkte, Regulierung, Fachkräftemangel. Das alles ist real und bremst viele Entwicklungen aus. Aber diese Faktoren erklären nicht vollständig, warum wir trotz exzellenter Forschung so selten globale Kategorie-Gewinner hervorbringen.

Der entscheidende Punkt ist aus meiner Sicht ein anderer: In Europa denken wir Technologie oft zu lange aus der Perspektive der Forschung und zu spät aus der Perspektive des Marktes. In den USA wird viel früher gefragt: Wer zahlt dafür? Wie schnell kommen wir in echte Deployment-Szenarien? In Europa fragen wir zu lange, ob die Technologie perfekt ist. Das führt dazu, dass viele DeepTech-Start-ups zu spät mit echten Kunden interagieren, zu spät lernen und zu spät Traktion aufbauen. Die strukturellen Themen sind ein Teil des Problems. Aber die Art, wie wir Unternehmen bauen und die fehlende frühe Kommerzialisierungslogik sind aus meiner Sicht größere Hebel.

StartingUp: Du hast als COO bei N26 massives Wachstum miterlebt – ein B2C-FinTech mit einer App. DeepTech bedeutet aber oft jahrelange Forschung, Hardware-Entwicklung, Patente und B2B-Sales-Zyklen, die ewig dauern. Wie viel B2C-Wachstums-Mindset lässt sich überhaupt auf hochkomplexe DeepTech-Unternehmen übertragen, ohne an der Realität zu scheitern?

Martin Schilling: Man kann DeepTech nicht wie ein B2C-FinTech skalieren. Das wäre naiv. Die Zyklen sind länger, die Kapitalintensität höher, und die technische Unsicherheit ist real. Aber das heißt nicht, dass man auf ein Wachstums-Mindset verzichten kann. Was übertragbar ist, sind nicht die Taktiken, sondern die Prinzipien: Geschwindigkeit im Lernen, radikale Kundenorientierung und der Anspruch, früh zu skalieren und nicht erst, wenn alles perfekt ist.

Was ich oft sehe ist, dass DeepTech-Teams jahrelang die Technologie optimieren, bevor sie ernsthaft in den Markt gehen. In dieser Zeit verlieren sie wertvolle Iterationen. Die besten Teams denken von Anfang an in Dual Tracks: Technologie entwickeln und parallel kommerzielle Hypothesen testen. Das bedeutet nicht, dass man Hardware-Zyklen beschleunigen kann. Aber man kann sehr wohl beschleunigen, wie schnell man versteht, wo echter Bedarf ist und wie Zahlungsbereitschaft entsteht.

StartingUp: Ein ständiger Kritikpunkt ist, dass der Zugang zu mutigem Kapital in Europa langsamer funktioniert als in den USA. Aber VCs sind keine Wohlfahrtsverbände, sie rechnen Risiko und Rendite durch. Müssen wir nicht vielleicht zugeben, dass viele europäische DeepTech-Cases geschäftlich einfach nicht attraktiv oder zu schlecht gepitcht sind, um ein amerikanisches Risikoprofil anzuziehen?

Martin Schilling: Es ist zu einfach, alles auf fehlendes Kapital zu schieben. Ja, die USA haben mehr Kapital und mehr Risikoappetit. Aber Kapital folgt am Ende immer überzeugenden Geschichten und vor allem überzeugender Traktion. Was ich in Europa oft sehe: Technologisch brillante Teams, aber schwache Positionierung, unklare Go-to-Market-Strategien und zu wenig Fokus auf kommerzielle Meilensteine. Viele Pitches sind technisch beeindruckend, aber beantworten nicht die entscheidende Frage, warum aus etwas ein erfolgreiches Geschäftsmodell wird. Das heißt nicht, dass es kein strukturelles Kapitalproblem gibt. Das gibt es. Aber wir müssen genauso ehrlich sagen: Ein Teil des Problems liegt in der Art, wie wir DeepTech-Unternehmen bauen und erzählen.

StartingUp: Du beobachtest somit, dass deutsche Start-ups oft nicht an der Technologie, sondern an Marktanbindung und Traktion scheitern. Wenn die Technologie exzellent ist, scheitert es dann am Menschlichen? Wie oft erlebst du, dass brillante Forschende aus Eitelkeit nicht loslassen können und sich weigern, den CEO-Posten an erfahrene Business- und Sales-Profis abzugeben?

Martin Schilling: Das Thema gibt es, aber ich würde es differenzierter sehen. DeepTech entsteht oft aus wissenschaftlicher Exzellenz. Und diese Gründer*innen bringen etwas extrem Wertvolles mit: tiefes Verständnis, langfristiges Denken und eine hohe technische Vision. Die Herausforderung entsteht, wenn diese Stärken nicht durch kommerzielle Kompetenz ergänzt werden. Ich erlebe weniger ein klassisches „Ego-Problem“, sondern eher ein Rollenproblem, denn viele Gründer*innen haben nie gelernt, was es bedeutet, ein Unternehmen zu skalieren. Das gilt insbesondere im B2B-Kontext. Die besten Teams lösen das sehr pragmatisch. Sie bauen früh komplementäre Führungsteams mit starkem Sales-, Operations- und Marktverständnis auf. Ob das dann ein externer CEO ist oder nicht, ist zweitrangig. Entscheidend ist, dass die Organisation die Fähigkeiten hat, nicht nur Technologie zu entwickeln, sondern sie auch zu verkaufen.

StartingUp: Um Start-ups, Corporates und Investor*innen zusammenzubringen, veranstaltest du im Mai das Event Deep Tech Momentum in Berlin. Aber ganz ehrlich: Es gibt in Europa und Deutschland bereits hunderte Start-up-Konferenzen, Summits und Matchmaking-Events. Warum sollte ausgerechnet ein weiterer Marktplatz das tiefgreifende strukturelle Problem lösen, dass die deutsche Industrie oft schlichtweg zu risikoavers ist, um bei jungen Start-ups einzukaufen?

Martin Schilling: Ich stimme dir zu. Es mangelt nicht an Events in Europa, wir haben eher zu viele davon. Der Unterschied bei Deep Tech Momentum ist, dass wir kein klassisches Konferenzformat sind, sondern ein Marktplatz. Was heißt das konkret? Wir bringen nicht einfach Leute zusammen, sondern orchestrieren konkrete Interaktionen zwischen Start-ups, Corporates und Investor*innen. Dabei verfolgen wir das klare Ziel, Deals, Partnerschaften und Deployment zu schaffen.

Bei Deep Tech Momentum kommen über 3.000 Senior Entscheider*innen zusammen. Über den Marktplatz wurden bereits mehr als 500 Millionen Euro an Investitionen und hunderte Partnerschaften angestoßen. Unser Ziel bis 2030 ist es, 100 Milliarden Euro zusätzliche DeepTech-Investitionen zu mobilisieren und 10.000 Partnerschaften zwischen Start-ups und Industrie zu ermöglichen.

Ein Beispiel ist unser Guardian Program. Dort bringen wir die Top 300 Senior Innovation Leaders aus führenden Unternehmen gezielt mit vorqualifizierten DeepTech-Start-ups zusammen, also mit Unternehmen, die echte Budgets, konkrete Anwendungsfälle und Entscheidungsmandate mitbringen. Damit packen wir aus meiner Sicht das Kernproblem Europas an: Wir verschaffen Zugang zu ersten Kunden und realen Anwendungen.

StartingUp: Durch langsames Wachstum entsteht ein Druck auf Gründer*innen, in die USA auszuweichen. Dort lockt der Markt gezielt mit Milliarden-Subventionen und schnellem Kapital. Was entgegnest du einem DeepTech-Gründer, der heute zu dir sagt: „Herr Schilling, Europa ist nett für die Forschung, aber um ein Einhorn zu bauen, muss ich sofort in die USA?“

Martin Schilling: Ich würde niemandem pauschal davon abraten, in die USA zu gehen. Für viele Modelle ist das absolut sinnvoll, gerade wenn es um Kapital und Marktskalierung geht. Aber ich würde zwei Dinge entgegnen. Erstens: Europa ist kein schlechter Ort, um ein DeepTech-Unternehmen zu bauen. Wir haben exzellente Forschung, starke Industriepartner und zunehmend auch Kapital. Zweitens – und wichtiger: Der Engpass ist oft nicht der Standort, sondern die Geschwindigkeit, mit der man Kommerzialisierung erreicht. Wenn ein Start-up es schafft, früh echte Kunden zu gewinnen, Piloten zu fahren und Umsatz aufzubauen, dann wird Kapital folgen, auch in Europa. Mit Deep Tech Momentum möchten wir den Weg von Technologie zur Anwendung beschleunigen. Denn es geht nicht um Europa vs. USA. Es geht darum, ob ein Unternehmen es schafft, aus Technologie ein funktionierendes Geschäft zu machen.

Danke, Martin Schilling, für die spannenden Insights

Das Interview führte StartingUp-Chefredakteur Hans Luthardt

Durchatmen in der KI-Ära: HR-Tech-Start-up Regulate sammelt 1,4 Mio. Euro ein

Ein neues B2B-Tool will die mentale Fitness in Unternehmen messbar machen. Hinter dem 2024 von Peter van Woerkum und Paul Laechelin gegründeten Münchner Breathwork-Start-up Regulate stehen prominente Szene-Köpfe. Doch kann eine App das grundlegende Problem struktureller Überlastung lösen?

Die Arbeitswelt verdichtet sich zusehends. Inmitten geopolitischer und wirtschaftlicher Unsicherheiten wird künstliche Intelligenz (KI) in alle Lebensbereiche integriert, was das Arbeitstempo spürbar beschleunigt. In diesem Spannungsfeld positioniert sich das Münchner Start-up Regulate. Das Unternehmen hat nun eine Seed-Finanzierungsrunde in Höhe von 1,4 Millionen Euro abgeschlossen.

Angeführt wird die Runde vom Impact-Investor 4impact.vc. Zu den Business Angels zählen zudem bekannte Namen der deutschen Startup-Szene, darunter Hanno Renner (Co-Founder & CEO, Personio), Mike Wax (Co-Founder, Forto), Marlena Hien (Co-Founder, Bears with Benefits) und Felix Haas (10x Group, Bits & Pretzels, IDnow).

Die Köpfe und die Historie

Hinter Regulate stehen CEO Peter van Woerkum und Paul Laechelin, die das Unternehmen im Jahr 2024 gründeten.

- Peter van Woerkum: Der Gründer ist ein zertifizierter Breathwork- und Executive-Coach, der auf über zehn Jahre Erfahrung in der C-Level-Beratung zurückblickt.

- Paul Laechelin: Als ehemaliger Product Lead für die BMW App bringt er die notwendige technische Expertise mit, um das Produkt für den Enterprise-Einsatz zu skalieren.

- Wissenschaftliches Fundament: Die inhaltliche Entwicklung der App erfolgte in Partnerschaft mit Prof. Dr. Hottenrott von der Martin-Luther-Universität Halle-Wittenberg. Die angebotenen Methoden basieren zudem auf Forschungen der Harvard Medical School und Stanford Medicine.

Das Geschäftsmodell: Präzision statt Gießkanne

Regulate grenzt sich bewusst von herkömmlichen Wellness-Apps ab. Anstatt allgemeine Meditationsübungen bereitzustellen, die in firmeninternen Benefit-Portalen oft ungenutzt bleiben, zielt die Plattform darauf ab, im passenden Moment die richtige Intervention anzubieten.

- Contextual Intelligence: Die App verknüpft sich mit Wearables und den digitalen Arbeitssystemen der Nutzer.

- On-Demand-Tool: Durch das Auslesen physiologischer Signale und die Analyse der Arbeitsstruktur werden personalisierte Atemübungen (Dauer: 90 Sekunden bis 60 Minuten) vorgeschlagen. Dies kann ein Fokus-Protokoll vor einem wichtigen Meeting oder eine Übung zur Beruhigung nach einer intensiven Diskussion sein.

- HR-Dashboard: Arbeitgeber erhalten aggregierte Dashboards, die HR- und Führungsteams Einblicke in Nutzungsmuster und Team-Resilienz geben, ohne die Privatsphäre des Einzelnen zu kompromittieren.

Das Geschäftsmodell stößt auf Resonanz: Innerhalb von weniger als zwölf Monaten wurden über 50.000 Sessions in der App absolviert. Die Enterprise-Pipeline umfasst ein potenzielles Volumen von über 9 Millionen Euro Annual Recurring Revenue (ARR). Zu den Kunden gehören unter anderem die Raiffeisen Bank International, Personio und Vattenfall. Mit dem neuen Kapital will Regulate das Wachstum beschleunigen, die Produktfunktionen vertiefen, Live-Formate ausbauen und europaweit expandieren.

Der Markt: Wachstumsdruck trifft auf Regulatorik

Regulate agiert in einem enormen Markt. Der globale Bereich für Stressmanagement am Arbeitsplatz wurde im Jahr 2023 auf 10,6 Milliarden US-Dollar geschätzt und wächst jährlich um 7,7 Prozent.

- Laut dem „State of the Global Workplace“ Report 2026 von Gallup gibt weltweit nur jede(r) dritte Arbeitnehmer*in an, am Arbeitsplatz zu „florieren“.

- Diese mangelnde Mitarbeiter*innenbindung kostet die Weltwirtschaft schätzungsweise 10 Billionen US-Dollar an ungenutzter Produktivität pro Jahr.

- Die Weltgesundheitsorganisation (WHO) bezifferte in einer Analyse von 2024 die zusätzlichen Kosten durch arbeitsplatzbedingte Angstzustände und Depressionen auf jährlich 1 Billion US-Dollar durch Produktionsausfälle.

Während in den USA vor allem direkte Gesundheitskosten die Arbeitgeberprogramme antreiben, wird der europäische Markt maßgeblich durch rechtliche Verpflichtungen geprägt. Die EU-Richtlinie zur Nachhaltigkeitsberichterstattung (CSRD) – seit Januar 2024 in Kraft – und die EU-Richtlinie zur Vereinbarkeit von Beruf und Privatleben zwingen Unternehmen zu mehr Transparenz und Berichterstattung beim Wohlbefinden der Belegschaft.

Unsere Einordnung: Heilsbringer oder Symptombekämpfung?

Aus Gründer*innen- und Investor*innensicht ist die Positionierung von Regulate strategisch klug. Der B2C-Markt für Achtsamkeit ist hochkompetitiv. Durch den strikten Fokus auf den B2B-Enterprise-Bereich und die nahtlose Integration in den Arbeitsalltag schafft Regulate eine starke Differenzierung. Besonders clever ist die Nutzung der europäischen CSRD-Richtlinie als Vertriebshebel: Unternehmen müssen Wohlbefinden reporten, Regulate liefert das passende aggregierte Dashboard direkt mit.

Trotzdem muss sich das Modell kritischen Fragen stellen:

- Symptombehandlung vs. Ursachenbekämpfung: Eine App kann strukturelle Überlastung durch Personalmangel, fehlendes Management oder toxische Unternehmenskulturen nicht lösen. Es besteht die Gefahr des „Wellbeing-Washings“, bei dem Unternehmen die Verantwortung für Stressbewältigung auf das Individuum abwälzen. CEO Peter van Woerkum betont zwar, dass die Plattform „keine weitere Stressquelle“ hinzufügen soll, doch in stark verdichteten Arbeitsumgebungen kann selbst ein technischer Push-Reminder zur Atemübung als belastend wahrgenommen werden.

- Datenschutz und Vertrauen: Die Koppelung physiologischer Wearable-Daten an ein vom Arbeitgeber finanziertes Dashboard betritt eine sensible Linie. Auch wenn Regulate betont, die Daten streng zu aggregieren, ist die Auswertung von Stressparametern am Arbeitsplatz – gerade in DACH-Unternehmen mit starken Betriebsräten – ein Terrain, das maximales Vertrauen der Belegschaft erfordert.

Fazit

Regulate hat erkannt, dass Corporate Health in Zukunft messbar und direkt in den Arbeitsalltag integriert sein muss. Kann das Start-up beweisen, dass seine Dashboards den Unternehmen helfen, Arbeitsbedingungen datenbasiert und strukturell zu verbessern, steht dem europaweiten Rollout kaum etwas im Wege.

Von Streaming bis Gaming – Diese Branchen profitieren vom digitalen Nutzerverhalten

Wie On-Demand-Modelle Branchen prägen und welche Erfolgsfaktoren Gründer jetzt kennen müssen.

Inhalte, Dienstleistungen und Unterhaltung werden zunehmend flexibel, mobil und individuell konsumiert. Während früher feste Zeiten und physische Angebote dominierten, stehen heute On-Demand-Modelle im Mittelpunkt. Diese Entwicklung wirkt sich nicht nur auf einzelne Produkte aus, sondern prägt ganze Branchen und schafft neue wirtschaftliche Dynamiken. Insbesondere digitale Geschäftsmodelle profitieren von der steigenden Erwartung an Verfügbarkeit, Geschwindigkeit und Personalisierung.

Digitales Nutzerverhalten im Wandel

Die Verschiebung der Nutzungsgewohnheiten von stationären Desktop-Lösungen hin zu mobilen Endgeräten ist der stärkste Treiber der aktuellen Digitalökonomie. On-Demand ist zum Standard geworden: Ob Content, Services oder Unterhaltung – die Erwartungshaltung der Konsumenten ist geprägt von sofortiger Verfügbarkeit und einer hohen Passgenauigkeit durch Personalisierung.

- Inhalte jederzeit abrufbar: Die zeitliche Entkopplung von linearen Sendeplänen oder Öffnungszeiten.

- Omnichannel-Nutzung: Ein nahtloser Übergang zwischen Smartphone, Tablet, Smart-TV und Laptop.

- Komfort als Zahlungsargument: Eine wachsende Bereitschaft, für Zeitersparnis und einfache Bedienbarkeit Abonnements abzuschließen.

Streaming als Vorreiter der digitalen Transformation

Streaming-Dienste gelten als eines der prägendsten Beispiele für die Anpassung an modernes Nutzerverhalten. Klassische Medienformate wurden durch Plattformen ersetzt, die Inhalte jederzeit zugänglich machen. Gleichzeitig haben sich abonnementbasierte Modelle etabliert, die stabile und planbare Einnahmen ermöglichen.

Ein zentraler Erfolgsfaktor liegt in der Nutzung von Daten. Algorithmen analysieren das Verhalten der Nutzer und liefern personalisierte Empfehlungen, wodurch die Verweildauer und Kundenbindung gesteigert werden. Für Unternehmen ergibt sich daraus ein skalierbares Modell, das sich international ausrollen lässt und kontinuierlich optimiert werden kann. Die Grenzkosten pro neuem Nutzer sind minimal. Eine starke Kundenbindung erfolgt hier primär durch exklusiven Content und ein personalisiertes Interface.

In diesem Bereich steht allerdings eine Wende bevor. Durch die große Akzeptanz und Nachfrage sind zahlreiche Angebote und dadurch ein fragmentierter Markt entstanden. Mehrere Abos pro Haushalt sind die Regel und Nutzer wünschen sich zunehmend eine Bündelung.

Gaming und interaktive Unterhaltung auf dem Vormarsch

Gaming hat sich von einer Nische zu einem der weltweit größten digitalen Märkte entwickelt und übertrifft in den Umsätzen längst die Film- und Musikindustrie zusammen. Besonders entscheidend ist hier der soziale Aspekt: Community-Building innerhalb der Spielewelten macht Gaming zu einem sozialen Netzwerk. Der Übergang zu Live-Events und Multiplayer-Erlebnissen schafft eine emotionale Bindung, die weit über das reine Konsumieren hinausgeht.

Gleichzeitig verschiebt sich der Fokus von einmaligen Käufen hin zu kontinuierlichen Einnahmequellen, etwa durch In-Game-Käufe oder abonnementbasierte Modelle. Diese Entwicklung zeigt, wie stark Nutzererlebnisse und soziale Komponenten den Erfolg digitaler Angebote beeinflussen.

iGaming als Teil der digitalen Entertainment-Ökonomie

Innerhalb der digitalen Unterhaltungslandschaft nimmt auch der iGaming-Bereich eine besondere Rolle ein. Dieser Sektor profitiert in ähnlicher Weise von technologischen Entwicklungen wie Streaming und Gaming, insbesondere durch mobile Nutzung, intuitive Benutzeroberflächen und schnelle Transaktionsmöglichkeiten.

Die Plattformen sind darauf ausgelegt, ein möglichst reibungsloses und immersives Nutzererlebnis zu bieten. Online Casino Schweiz präsentiert eine klare Strukturierung unterschiedlicher Games sortiert nach Themen oder Anbietern. Above the fold finden Nutzer Infos zu aktuellen Top-Gewinnern, Verlosungs-Aktionen oder neuen Titeln. Die Kombination aus Gamification-Elementen, internationaler Skalierbarkeit und datenbasierter Optimierung macht diesen Markt aus wirtschaftlicher Perspektive besonders interessant.

Typische Merkmale dieser Branche sind:

- hohe Nutzerbindung durch spielerische Elemente

- globale Ausrichtung digitaler Plattformen

- kontinuierliche Anpassung durch Nutzerdaten

Wirtschaftlichkeit und Transferpotenzial

Die Branche zeichnet sich durch überdurchschnittlich hohe operative Margen aus, da nach der initialen Entwicklung der Plattform und der Integration von Content die Skalierungskosten gering bleiben. Während Marketing- und Lizenzkosten substanziell sind, ermöglichen automatisierte Prozesse in der Kundenverwaltung und Zahlungsabwicklung eine hohe Profitabilität.

Diese Effizienz lässt sich auf andere digitale Angebote übertragen: Das Prinzip der Mikro-Interaktionen und die sofortige Belohnung (Instant Gratification) sind Mechanismen, die auch im E-Commerce oder in Produktivitäts-Apps die Conversion-Rate steigern. Wer lernt, die im iGaming perfektionierten Methoden der Datenanalyse und Echtzeit-Personalisierung zu nutzen, kann die Kundenbindung in nahezu jedem digitalen Geschäftsmodell signifikant erhöhen.

Was Gründer daraus lernen können

Die Analyse erfolgreicher digitaler Branchen zeigt klare Muster. Im Mittelpunkt steht nicht die Technologie selbst, sondern deren Anwendung im Kontext realer Nutzerbedürfnisse. Plattformdenken, Datenanalyse und eine konsequente Ausrichtung auf Benutzerfreundlichkeit sind zentrale Erfolgsfaktoren.

Konkrete Impulse:

- Verhalten statt Produkt: Geschäftsmodelle sollten dort ansetzen, wo Nutzer bereits Zeit verbringen oder Reibungsverluste erleben.

- Iteration: Schnelles Testing von Funktionen (MVP-Ansatz) ermöglicht es, am Puls der Zielgruppe zu bleiben.

- Mobile-First-Denkweise: Jede Lösung muss primär auf dem kleinsten Bildschirm perfekt funktionieren.

- Entwicklung skalierbarer Plattformlösungen

Das digitale Nutzerverhalten entwickelt sich dynamisch weiter und beeinflusst zahlreiche Branchen nachhaltig. Unternehmen, die diese Veränderungen frühzeitig erkennen und in ihre Strategien integrieren, sichern sich entscheidende Wettbewerbsvorteile. Besonders erfolgreich sind Modelle, die Flexibilität, Personalisierung, einfache Zugänglichkeit und die Einbindung in starke App-Ökosysteme miteinander verbinden. In einer zunehmend digitalen Wirtschaft entstehen neue Chancen vor allem dort, wo technologische Möglichkeiten auf veränderte Erwartungen treffen.

Weitere Gewinner des Nutzerwandels

Neben Unterhaltung und Gaming profitieren auch andere Branchen vom veränderten Verhalten. Besonders deutlich wird dies in Bereichen, die auf flexible Nutzung und personalisierte Angebote setzen.

Dazu zählen unter anderem:

- E-Learning-Plattformen, die ortsunabhängiges Lernen ermöglichen

- Fitness- und Gesundheits-Apps, die individuelle Trainingspläne bieten

- Fintech-Lösungen, die schnelle und unkomplizierte Zahlungsprozesse unterstützen

Gemeinsam ist diesen Geschäftsmodellen eine starke Nutzerzentrierung. Sie bieten Lösungen, die sich nahtlos in den Alltag integrieren lassen und dabei individuelle Bedürfnisse berücksichtigen.

Was Gründer daraus lernen können

Der entscheidende Erfolgsfaktor in der digitalen Ökonomie ist die radikale Nutzerzentrierung. Erfolgreiche Unternehmen denken nicht mehr in isolierten Produkten, sondern in Plattformen, die ein Problem ganzheitlich lösen. Die Bedeutung von Datenanalyse zur stetigen Verbesserung der UX kann dabei nicht überschätzt werden.

Die Verfestigung digitaler Gewohnheiten ist ein unumkehrbarer Prozess. Neue Märkte werden dort entstehen, wo technologische Möglichkeiten auf neue menschliche Bedürfnisse treffen. Die größten Chancen liegen für Gründer und etablierte Unternehmen dort, wo sich das Nutzerverhalten schneller wandelt als die bestehenden, oft noch trägen Angebote am Markt.

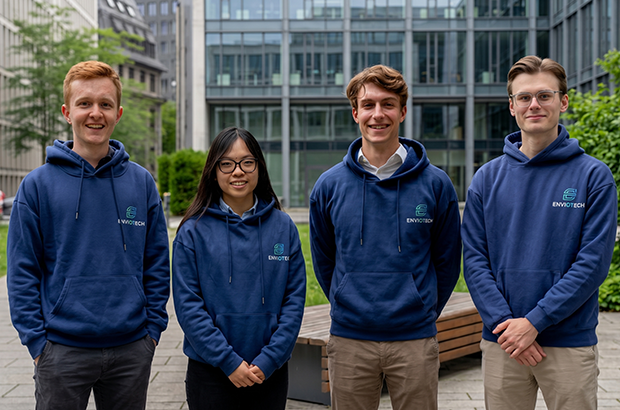

ENVIOTECH sichert sich Millionenfinanzierung für intelligente öffentliche Straßenbeleuchtung

Das Frankfurter Start-up ENVIOTECH rund um Adrian Rhaese, Linh Pham, Dustin Arnold und Peter Kletsko hat eine Pre-Seed-Runde in Höhe von einer Million Euro abgeschlossen, um öffentliche Straßenbeleuchtung intelligent nachzurüsten. Doch der Markt für kommunale Infrastruktur ist hart umkämpft und bürokratisch. Kann das junge Team die öffentlichen Verwaltungen überzeugen?

Es ist ein klassisches Gründer*innen-Narrativ: Aus einem persönlichen Schmerzpunkt entsteht eine Geschäftsidee. Im Fall von ENVIOTECH war es ein Fahrradunfall. Der beste Freund von Mitgründer Adrian Rhaese verunglückte, weil in einer deutschen Stadt die Straßenlaternen aufgrund gestiegener Stromkosten abgeschaltet worden waren. Dieser Vorfall weckte bei Rhaese das Unverständnis darüber, dass in einem wirtschaftlich starken Land ausgerechnet an der Sicherheit gespart wird – und legte den Grundstein für das Smart-City-Start-up.

Bye-bye Bankenturm: Der Sprung ins kalte Wasser

Anstatt ihren als sicher geltenden Karriereweg fortzusetzen, verließen Adrian Rhaese und Mitgründerin Linh Pham ihre Positionen als duale Studierende bei der Deutschen Bank. Sie entschieden sich bewusst für das unternehmerische Risiko, um reale Infrastrukturprobleme zu lösen.

Eine erste Bestätigung für diesen Schritt erhielt das junge Team durch die Aufnahme in das EWOR Fellowship. Daniel Dippold, Gründer und CEO von EWOR, bescheinigt dem Team den richtigen Fokus: „Unspektakuläre Infrastruktur gewinnt langfristig fast immer. Straßenbeleuchtung ist nicht glamourös, aber sie ist allgegenwärtig, unverzichtbar und aus keiner Stadt wegzudenken.“

Plug-and-Play am Lichtmast: Das 15-Minuten-Update

Die technische Lösung von ENVIOTECH setzt auf Pragmatismus: Anstatt Laternen kostenintensiv komplett auszutauschen, bietet das Unternehmen ein Retrofit-System an. Das Produkt soll sich laut Unternehmensangaben in unter 15 Minuten in bestehende Leuchten integrieren lassen.

Die nachgerüsteten Laternen kommunizieren als Mesh-Netzwerk miteinander und dimmen das Licht KI-gesteuert und bedarfsgerecht anhand von Bewegungserkennung. Das Startup verspricht dadurch Energieeinsparungen von bis zu 80 Prozent; gleichzeitig soll die öffentliche Sicherheit erhöht werden. Kommunen erhalten so die Möglichkeit, ihre Beleuchtung zentral zu steuern und in Echtzeit zu überwachen.

Um das Konzept in die Fläche zu tragen, konnte ENVIOTECH nun eine Pre-Seed-Finanzierung in Höhe von 1 Million Euro einsammeln. Angeführt wird die Runde passenderweise vom ehemaligen Co-CEO der Deutschen Bank, Jürgen Fitschen. Ergänzt wird das Konsortium durch Ex-MAN-CEO Joachim Drees, Alexander Eyhorn (Gründer von Bidirex) und Danilo Jovicic-Albrecht (Mitgründer des auf Kommunen spezialisierten Startups Vialytics). Mit dem frischen Kapital sollen Pilotprojekte forciert und das Technologieportfolio weiterentwickelt werden.

Der Endgegner heißt B2G-Markt: David gegen die Industrie-Goliaths

So einleuchtend die Technologie klingt, das Geschäftsmodell von ENVIOTECH steht vor gewaltigen Hürden. Der B2G-Markt (Business-to-Government) ist für Start-ups extrem schwierig. Kommunen, die ENVIOTECHs primäre Zielgruppe darstellen, arbeiten mit langen Budgetzyklen und streng regulierten öffentlichen Ausschreibungsverfahren. Bis ein Pilotprojekt zu einem flächendeckenden Rollout führt, vergehen oft Jahre.

Darüber hinaus agiert das Start-up nicht im luftleeren Raum. Der Smart-Lighting-Markt wird von Industriegiganten wie Signify oder Schréder dominiert, die längst eigene IoT-Lichtsteuerungssysteme anbieten. Auch andere Start-ups wie Tvilight oder Icegateway haben das Potenzial vernetzter Straßenbeleuchtung erkannt.

Der entscheidende USP von ENVIOTECH muss daher in der Geschwindigkeit und Einfachheit liegen: Gelingt die versprochene rasante Installation und können Kommunen die Lösung ohne massive Tiefbauarbeiten testen, hat das Start-up einen echten Wettbewerbsvorteil. Besonders klug ist hierbei die Auswahl der Investor*innen: Mit Drees und Jovicic-Albrecht hat das Gründerduo Köpfe an Bord geholt, die wissen, wie man komplexe Produkte an die öffentliche Hand verkauft. Schafft es ENVIOTECH, den extrem zähen Vertriebszyklus öffentlicher Verwaltungen zu knacken, könnte das Unternehmen zu einem hochrentablen Hidden Champion heranwachsen.

Württemberger Medien: Nachhaltige Wachstumsstrategien

Wie die Württemberger Medien Marketing Agentur Unternehmen mit datengetriebenen Strategien und klarer Positionierung unterstützt.

Digitale Sichtbarkeit ist heute für Unternehmen kein optionaler Erfolgsfaktor mehr, sondern eine Grundvoraussetzung. Märkte werden transparenter, Wettbewerber sichtbarer und Kunden anspruchsvoller. Wer sich behaupten will, muss nicht nur präsent sein, sondern gezielt kommunizieren, analysieren und optimieren. Genau an dieser Schnittstelle zwischen Strategie, Technologie und Kommunikation setzt die wtv Online Marketing Agentur an.

Das Unternehmen hat sich darauf spezialisiert, digitale Potenziale strukturiert zu erschließen und für seine Kunden messbar zu machen. Dabei geht es nicht um kurzfristige Maßnahmen oder einzelne Kampagnen, sondern um nachhaltige Strategien, die Wachstum langfristig unterstützen.

Von der Idee zur klaren digitalen Strategie

Viele Unternehmen starten mit einzelnen Marketingmaßnahmen, ohne eine übergeordnete Strategie zu verfolgen. Social-Media-Kanäle werden aufgebaut, Anzeigen geschaltet oder Inhalte produziert – oft ohne klare Zielsetzung oder langfristige Planung. Das Ergebnis: hohe Aufwände bei begrenzter Wirkung.

Die Württemberger Medien Agentur verfolgt bewusst einen anderen Ansatz. Im Mittelpunkt steht zunächst die Analyse. Bevor Maßnahmen umgesetzt werden, geht es darum, das Unternehmen, die Zielgruppe und den Markt genau zu verstehen.

Dazu gehören unter anderem:

- die Definition klarer Ziele und Zielgruppen

- die Analyse bestehender Marketingaktivitäten

- die Bewertung von Wettbewerbern und Marktposition

- die Identifikation von Potenzialen und Schwachstellen

Auf dieser Grundlage entsteht eine individuelle Strategie, die nicht nur kurzfristige Erfolge ermöglicht, sondern langfristig trägt.

Datenbasierte Entscheidungen statt Bauchgefühl

Ein wesentlicher Unterschied moderner Online-Marketing-Ansätze liegt in der Nutzung von Daten. Während Marketing früher oft stark von Erfahrung und Intuition geprägt war, stehen heute umfangreiche Analysemöglichkeiten zur Verfügung.

Die Württemberger Medien Agentur nutzt diese Möglichkeiten gezielt, um fundierte Entscheidungen zu treffen. Daten werden nicht nur gesammelt, sondern interpretiert und in konkrete Maßnahmen übersetzt. Dadurch lassen sich Maßnahmen kontinuierlich optimieren und Budgets effizient einsetzen.

Diese Arbeitsweise bringt mehrere Vorteile mit sich:

- bessere Planbarkeit von Marketingmaßnahmen

- transparente Erfolgsmessung

- gezielte Optimierung einzelner Kanäle

- langfristige Skalierbarkeit von Strategien

Gerade für wachsende Unternehmen ist diese Transparenz ein entscheidender Faktor.

Ganzheitlicher Blick auf digitale Kanäle

Online-Marketing besteht heute aus einer Vielzahl unterschiedlicher Disziplinen. Suchmaschinenoptimierung, Performance Marketing, Content-Strategie und Social Media greifen ineinander und beeinflussen sich gegenseitig.

Die Württemberger Medien Agentur betrachtet diese Bereiche nicht isoliert, sondern als Teil eines Gesamtsystems. Ziel ist es, die einzelnen Kanäle sinnvoll miteinander zu verknüpfen und so eine konsistente Markenkommunikation zu schaffen.

Dabei werden unter anderem folgende Bereiche integriert:

- Suchmaschinenoptimierung (SEO) für nachhaltige Sichtbarkeit

- Webdesign und Website-Entwicklung für einen professionellen digitalen Auftritt

- Digitale Mitarbeitergewinnung über zielgerichtete Online-Kampagnen

- Ganzheitliche strategische Beratung zur digitalen Sichtbarkeit und Kundengewinnung

Durch diese Verzahnung entsteht ein Marketingansatz, der sowohl kurzfristige Ergebnisse als auch langfristige Wirkung ermöglicht.

Fokus auf messbare Ergebnisse

Ein zentraler Anspruch der Württemberger Medien ist die Messbarkeit von Erfolg. Marketing wird nicht als kreativer Selbstzweck verstanden, sondern als strategisches Instrument zur Erreichung konkreter Unternehmensziele.

Das bedeutet, dass jede Maßnahme klar definierten Kennzahlen zugeordnet wird. Ob Traffic, Conversion-Rate oder Umsatz – die Ergebnisse werden kontinuierlich überprüft und ausgewertet.

Diese Transparenz schafft Vertrauen und ermöglicht es Kunden, ihre Investitionen nachvollziehbar zu steuern. Gleichzeitig bildet sie die Grundlage für eine kontinuierliche Weiterentwicklung der Strategie.

Zusammenarbeit auf Augenhöhe

Neben fachlicher Expertise spielt auch die Zusammenarbeit eine entscheidende Rolle. Die Württemberger Medien Agentur versteht sich nicht als externer Dienstleister im klassischen Sinne, sondern als strategischer Partner.

Das zeigt sich vor allem in der Kommunikation. Projekte werden eng mit den Kunden abgestimmt, Entscheidungen transparent getroffen und Entwicklungen regelmäßig besprochen. Ziel ist es, gemeinsam Lösungen zu entwickeln, die zum jeweiligen Unternehmen passen.

Diese partnerschaftliche Herangehensweise bringt mehrere Vorteile:

- klare Abstimmung von Zielen und Erwartungen

- schnelle Anpassung an Veränderungen

- langfristige Zusammenarbeit statt kurzfristiger Projekte

- bessere Integration in bestehende Unternehmensstrukturen

Gerade in dynamischen Märkten ist diese Flexibilität ein wichtiger Erfolgsfaktor.

Anpassungsfähigkeit in einem dynamischen Umfeld

Die digitale Welt verändert sich kontinuierlich. Neue Plattformen entstehen, Algorithmen werden angepasst und Nutzerverhalten entwickelt sich weiter. Für Unternehmen bedeutet das, dass Strategien regelmäßig überprüft und angepasst werden müssen.

Die Württemberger Medien Agentur begegnet dieser Dynamik mit einem flexiblen Ansatz. Statt starrer Konzepte setzt sie auf kontinuierliche Optimierung und Anpassung. Entwicklungen werden frühzeitig erkannt und in die Strategie integriert.

Dadurch bleiben Kunden nicht nur wettbewerbsfähig, sondern können neue Chancen aktiv nutzen.

Branchenübergreifende Erfahrung

Ein weiterer Vorteil der Württemberger Medien Online Marketing Agentur liegt in ihrer branchenübergreifenden Erfahrung. Zu den Kunden des Unternehmens zählen lokale und regionale Dienstleister, Handwerks- und Gewerbebetriebe sowie Unternehmen aus dem Mittelstand. Dadurch entsteht ein breites Verständnis für verschiedene Geschäftsmodelle, Zielgruppen und Marktmechaniken.

Diese Vielfalt hilft dabei, funktionierende Strategien nicht isoliert zu betrachten, sondern sinnvoll auf andere Bereiche zu übertragen. Was bei einem Dienstleistungsunternehmen zu mehr Sichtbarkeit und Anfragen führt, kann, richtig angepasst, auch für Handwerks- und Gewerbebetriebe sehr gut funktionieren. Gleichzeitig entstehen durch diese Perspektivwechsel oft innovative Ansätze, die über klassische Lösungen hinausgehen.

Dennoch bleibt jede Strategie individuell. Die Württemberger Medien Agentur setzt nicht auf standardisierte Konzepte, sondern passt Maßnahmen präzise an die jeweiligen Anforderungen an. Marktumfeld, Wettbewerbssituation und Zielgruppe werden dabei ebenso berücksichtigt wie interne Strukturen und Ressourcen des Kunden.

So entsteht ein ausgewogenes Verhältnis zwischen Erfahrung und Individualität – eine Kombination, die es ermöglicht, sowohl effizient als auch kreativ zu arbeiten und nachhaltige Ergebnisse zu erzielen.

Nachhaltiges Wachstum statt kurzfristiger Erfolge

Im Zentrum der Arbeit steht ein klares Ziel: nachhaltiges Wachstum. Während viele Marketingmaßnahmen auf schnelle Ergebnisse ausgerichtet sind, verfolgt die Württemberger Medien Agentur einen langfristigen Ansatz. Es geht nicht darum, kurzfristig Aufmerksamkeit zu erzeugen, sondern darum, stabile Strukturen aufzubauen, die dauerhaft funktionieren.

Das bedeutet, dass nicht nur einzelne Kampagnen optimiert werden, sondern das gesamte digitale Fundament eines Unternehmens gestärkt wird. Sichtbarkeit in Suchmaschinen, eine klare Markenpositionierung und eine gezielte Kundenansprache werden Schritt für Schritt aufgebaut und kontinuierlich weiterentwickelt.

Dabei spielen mehrere Faktoren zusammen. Eine technisch optimierte Website sorgt für eine bessere Auffindbarkeit, ein professioneller Markenauftritt stärkt die Außenwirkung und datenbasierte Kampagnen bringen gezielt Reichweite. Durch diese Kombination entsteht ein System, das nicht von einzelnen Maßnahmen abhängig ist, sondern als Ganzes wirkt.

Ein weiterer Vorteil dieses Ansatzes liegt in der Planbarkeit. Unternehmen erhalten eine klare Perspektive, wie sich ihre Marketingaktivitäten entwickeln und welche Ergebnisse realistisch zu erwarten sind. Gleichzeitig bleibt genügend Flexibilität, um auf Veränderungen im Markt zu reagieren und neue Chancen zu nutzen.

Dieser Fokus auf langfristige Entwicklung sorgt dafür, dass Unternehmen nicht nur kurzfristig wachsen, sondern sich nachhaltig im Wettbewerb positionieren können.

Fazit

Die Anforderungen an modernes Online-Marketing sind heute komplexer denn je. Unternehmen müssen sich in einem dynamischen Umfeld behaupten, ihre Zielgruppen verstehen und gleichzeitig effizient arbeiten. Gleichzeitig steigt der Druck, Marketingmaßnahmen nicht nur umzusetzen, sondern auch deren Wirkung nachvollziehbar zu machen.

Die Württemberger Medien Marketing Agentur zeigt, wie sich diese Herausforderungen strukturiert und zielgerichtet angehen lassen. Durch die Kombination aus datenbasierter Analyse, strategischer Planung und kontinuierlicher Optimierung entstehen Lösungen, die messbare Ergebnisse liefern und gleichzeitig langfristig tragen.

Besonders hervorzuheben ist der ganzheitliche Ansatz. Statt isolierter Maßnahmen entwickelt die Agentur ein umfassendes System, in dem alle digitalen Kanäle sinnvoll miteinander verknüpft sind. Dadurch wird nicht nur kurzfristige Sichtbarkeit erzeugt, sondern eine stabile Grundlage für nachhaltiges Wachstum geschaffen.

Für Unternehmen, die ihre digitale Präsenz gezielt ausbauen und langfristig stärken möchten, bietet dieser Ansatz eine klare Orientierung. Er verbindet Strategie, Technologie und Kommunikation zu einem durchdachten Gesamtbild – und schafft damit die Voraussetzungen für kontinuierlichen Erfolg in einem sich ständig verändernden Marktumfeld.

Wie das TechBio-Start-up mbiomics mit 30 Mio. Euro die Krebstherapie skalierbar machen will

Stuhltransplantationen haben gezeigt, dass das Darmmikrobiom ein mächtiger Hebel gegen Krebs sein kann – doch der Ansatz ist bisher kaum standardisierbar. Das Münchner Unternehmen mbiomics setzt auf künstliche Intelligenz und maßgeschneiderte Bakterien-Cocktails aus dem Labor. Mit dem Abschluss einer 30-Millionen-Euro-Serie-A-Runde rückt die klinische Phase näher. Ein genauer Blick auf das Geschäftsmodell, die Gründer*innen und einen hart umkämpften globalen Markt.

Wer heute von modernster Krebstherapie spricht, kommt am menschlichen Darm nicht mehr vorbei. Die wissenschaftliche Datenlage der letzten Jahre hat sich massiv verdichtet: Ob ein Patient auf revolutionäre Krebs-Immuntherapien (wie Immun-Checkpoint-Inhibitoren) anspricht, hängt maßgeblich von der individuellen Zusammensetzung seines Mikrobioms ab. Das Münchner TechBio-Unternehmen mbiomics hat sich genau dieses Zusammenspiel zur Mission gemacht und gab heute den dritten Abschluss seiner Serie-A-Finanzierungsrunde bekannt. Mit neu eingeworbenen 12 Millionen Euro wächst das Gesamtvolumen der Runde auf beachtliche 30 Millionen Euro.

Das Kapital, das unter anderem von erfahrenen Investoren wie den MIG Fonds und Bayern Kapital stammt, markiert für das 2020 gegründete Unternehmen einen entscheidenden Wendepunkt: den Übergang von der reinen Technologieplattform hin zur klinischen Anwendung am Menschen. Der führende Wirkstoffkandidat „MBX-116“ soll 2027 in einer Phase-1B-Studie an Patienten mit fortgeschrittenem schwarzen Hautkrebs (Melanom) getestet werden. Doch wie belastbar ist dieser Ansatz im Vergleich zum Wettbewerb?

Die Köpfe hinter der Vision

Aus der Taufe gehoben wurde mbiomics im Jahr 2020 von Dr. Laura Figulla, Dr. Johannes B. Wöhrstein und Dr. Markus Rinecker. Während die Mitgründer Figulla und Rinecker das Unternehmen in der frühen Phase prägten, wird die nun anstehende Skalierung und klinische Validierung von einem spezialisierten Leadership-Trio gesteuert:

- Dr. Johannes B. Wöhrstein (CEO & Mitgründer): Als technologischer Kopf und Geschäftsführer verantwortet er die firmeneigene Plattform. Seine Expertise in hochauflösender Analytik ist das Fundament, um komplexe mikrobielle Netzwerke mithilfe von maschinellem Lernen (KI/ML) überhaupt erst zu kartieren.

-

Kristin Torre Vinuesa (CFO): Als Chief Financial Officer verantwortet sie die finanziellen Geschicke des Unternehmens. Ihre Rolle ist entscheidend, um die neu eingeworbenen 30 Millionen Euro strategisch einzusetzen, den naturgemäß hohen Kapitalbedarf der anstehenden klinischen Studien („Cash Burn“) effizient zu steuern und das finanzielle Fundament für zukünftige Runden zu sichern.

- Dr. Christopher Weidenmaier (CSO): Der erfahrene Mikrobiologe (zuvor unter anderem beim US-Konkurrenten Finch Therapeutics) komplettiert das heutige Führungstrio. Als Chief Scientific Officer leitet er die präklinische Forschung und treibt das rationale Design der komplexen Bakterien-Konsortien maßgeblich voran.

Das Problem: Die Unberechenbarkeit der Natur

Um das Geschäftsmodell zu verstehen, muss man den Status quo betrachten. In der Onkologie wird aktuell intensiv mit Stuhltransplantationen (Fecal Microbiota Transplants, FMT) experimentiert. Dabei wird das Mikrobiom von Patient*innen, die hervorragend auf Krebsmedikamente ansprechen, auf „Non-Responder“ übertragen. Die Erfolge sind bemerkenswert, doch das Verfahren hat einen massiven Haken: Stuhl ist ein hochvariables Naturprodukt. Er ist schwer zu standardisieren, birgt Infektionsrisiken und lässt sich nicht als skalierbares Pharma-Produkt im industriellen Maßstab herstellen.

Hier setzt mbiomics mit sogenannten Live Biotherapeutic Products (LBPs) an. Statt auf ungefilterte Spender*innen-Transplantate zu setzen, identifiziert das Team mittels KI genau jene Bakterienstämme, die für den therapeutischen Effekt verantwortlich sind. Diese werden dann im Labor nach pharmazeutischen GMP-Standards gezüchtet und als orale Kapsel verabreicht. Es ist der Versuch, die „Blackbox“ Darm in ein berechenbares, patentierbares Medikament zu verwandeln.

Wo liegen die Risiken?

Für Beobachter*innen der Start-up-Szene bleibt das Vorhaben trotz der Millionen-Finanzierung eine Hochrisiko-Wette. Ein TechBio-Start-up in diesem Stadium hat einen enormen „Cash Burn“. Die 30 Millionen Euro sind ein starkes Fundament, doch die klinische Entwicklung in der Onkologie ist ein Langstreckenlauf, der oft dreistellige Millionenbeträge verschlingt.

Zudem ist das Geschäftsmodell hochgradig binär: Die für 2027 geplante Studie muss erst beweisen, dass die im Labor designten Bakterien-Konsortien im komplexen menschlichen Ökosystem tatsächlich die erhoffte Wirkung zeigen. Ein Scheitern des Leitkandidaten MBX-116 könnte das gesamte Vertrauen in die Plattform erschüttern. Zudem ist die Herstellung lebender Bakterien in absolut reproduzierbarer Qualität eine enorme logistische und biotechnologische Herausforderung, an der bereits andere Pioniere der Branche hängen geblieben sind.

Der Markt: Ein globales Rennen

Mbiomics ist nicht allein auf diesem Feld. Das Unternehmen muss sich gegen hochkapitalisierte internationale Konkurrent*innen behaupten:

- MaaT Pharma (Frankreich): Die Franzosen sind klinisch bereits weiter fortgeschritten und setzen auf „Full-Ecosystem“-Produkte aus gepoolten Spenderproben. Mbiomics muss beweisen, dass ihr synthetischer Präzisions-Ansatz dem natürlichen Mix überlegen ist.

- Vedanta Biosciences (USA): Ein US-Schwergewicht, das ebenfalls definierte Bakterienkonsortien entwickelt und bereits über ein breites Netzwerk an Kooperationen mit der Big-Pharma-Industrie verfügt.

Unsere Einordnung

Für das deutsche Ökosystem ist der Erfolg von mbiomics ein Leuchtturm-Signal. Dass Investoren wie MIG – die bereits bei BioNTech ein frühes Gespür bewiesen – hier massiv nachlegen, unterstreicht die Qualität des Standorts München.

Mbiomics wählt den schwierigen, aber potenziell nachhaltigeren Weg. Statt auf die bloße Kopie der Natur zu setzen, versucht das Team, das Mikrobiom durch Daten beherrschbar zu machen. Gelingt der klinische Wirksamkeitsnachweis ab 2027, könnte das Start-up nicht nur die Onkologie verändern, sondern auch Blaupausen für die Behandlung von Autoimmun- und neurodegenerativen Erkrankungen liefern. Der Weg bis dahin bleibt jedoch teuer und wissenschaftlich riskant.

Tatendrang trifft Struktur – Ist Deutschland wirklich innovationsmüde?

Gründer*innen haben Gestaltungswillen, aber Bürokratie wirkt als tödliche Handbremse. Im Experten-Interview verrät Zukunftsberater und Start-up-Mentor Dr. Jenkis, was sich jetzt ändern muss.

In der öffentlichen Debatte wird Deutschland oft als Land der Bedenkenträger*innen und der bürokratischen Starre gezeichnet. Doch während die Medien über eine allgemeine Verunsicherung berichten, zeigt ein Blick in die Werkstätten und Büros von Gründer*innen und Unternehmer*innen ein anderes Bild: Hier herrscht „Gestaltungslust“ statt Stillstand.

Eine aktuelle Umfrage der ZUKUNFTSWERKE GmbH mit dem Titel „TATENDRANG TRIFFT STRUKTUR: Innovation im Spannungsfeld zwischen Willen und Wirklichkeit“ räumt mit gängigen Klischees auf. Die Ergebnisse belegen, dass der unternehmerische Kern längst auf Aufbruch programmiert ist: 32 Prozent der Befragten treibt der Wille an, die Zukunft aktiv zu gestalten.

Dr. Dirk Jenkis ist Zukunftsberater und Start-up-Mentor sowie der Kopf hinter ZUKUNFTSWERKE und Experte für die Dynamiken zwischen unternehmerischem Willen und strukturellen Rahmenbedingungen. Warum Innovationen oft auf halber Strecke stecken bleiben und warum das Problem weniger in den Köpfen als in den Strukturen liegt, erklärt er im Interview.

Herr Dr. Jenkis, Ihre Studie zeigt: 32 % der Unternehmer*innen wollen Zukunft aktiv gestalten, statt sie nur zu verwalten. Warum klafft die Schere zwischen diesem inneren Tatendrang und der öffentlichen Wahrnehmung einer „lahmenden Wirtschaft“ so weit auseinander?

Dr. Jenkis: Weil wir zwei völlig unterschiedliche Bilder betrachten. Innen sehe ich Unternehmer mit Energie, Ideen und einem klaren Gestaltungswillen. Außen diskutieren wir oft über Symptome: schwaches Wachstum, zähe Prozesse, Unsicherheit. Das Problem ist nicht fehlender Tatendrang. Das Problem ist, dass dieser Tatendrang in einem Umfeld stattfindet, das ihn oftmals ausbremst. Wenn Sie ständig gegen Bürokratie, langsame Verfahren oder unklare Regeln anlaufen, wirkt selbst die dynamischste Organisation irgendwann träge. Die Wirtschaft ist also nicht lahm. Sie läuft nur oft mit angezogener Handbremse.

Mut (27 %) und Neugier (23 %) sind laut Umfrage die wichtigsten Zutaten für Innovation. Warum ist das „Entscheiden ohne vollständige Datenbasis“ heute die wichtigste Kernkompetenz für Gründende?

Dr. Jenkis: Weil die Welt schneller ist als jede Datengrundlage. Wer wartet, bis alles sicher ist, kommt schlicht zu spät. Gründer bewegen sich immer im Ungewissen. Genau dort entsteht Innovation. Mut heißt nicht Leichtsinn, sondern beschreibt die Fähigkeit, mit Unsicherheit produktiv umzugehen.

Und Neugier sorgt dafür, dass man die richtigen Fragen stellt, statt nur auf Antworten zu warten. Die Kombination aus beidem ist entscheidend: neugierig denken, mutig handeln. Wer das beherrscht, hat einen echten Wettbewerbsvorteil.

Ihre Studie weist darauf hin, dass die gefürchtete Risikoaversion oft bei Kapitalgeber*innen und Investor*innen sitzt. Wie pitcht man als Start-up erfolgreich gegen ein Umfeld an, das zwar Innovation fordert, aber offensichtlich Angst vor dem Scheitern hat?

Dr. Jenkis: Indem man Klarheit schafft. Investoren reagieren nicht auf Vision allein, sondern auf nachvollziehbare Logik. Ein guter Pitch verbindet Mut mit Struktur. Er zeigt: Ich weiß, was ich tue, auch wenn ich nicht alles weiß. Gleichzeitig braucht es auf der Investorenseite mehr Bereitschaft, Risiko als Teil von Innovation zu akzeptieren. Kapitel entscheidet mit darüber, wie viel Innovation möglich wird. Wer nur sichere Wetten eingeht, bekommt keine Durchbrüche.

Die größte Bremse ist nicht der mangelnde Wille, sondern fehlende Ressourcen und regulatorische Hürden. Ist der „Innovationsstandort Deutschland“ also eher ein Sanierungsfall der Strukturen als ein Problem der Köpfe?

Dr. Jenkis: Es ist ganz klar ein Strukturthema. Ich habe in den Antworten dieser Studie sehr viel Energie gesehen. Sehr viel Bereitschaft, Verantwortung zu übernehmen und Neues zu schaffen. Was fehlt, sind oft Geschwindigkeit, Verlässlichkeit und Einfachheit im System. Das Gute daran ist aber: Strukturen lassen sich verändern, wesentlich leichter als Mindset. Und genau darin liegt die Chance. Wir müssen nicht erst Motivation erzeugen. Wir müssen die vorhandene Motivation freisetzen und Gründern mehr Steine aus dem Weg räumen.

15 % der Befragten klagen über zu viele Prozesse und zu wenig Freiheitsgrade. Wie bewahren sich Start-ups beim Wachsen ihre Agilität, ohne in die „Konzern-Falle“ zu tappen?

Dr. Jenkis: Die „Konzern-Falle“ entsteht, wenn Prozesse zum Selbstzweck werden. Wachstum braucht Struktur, aber Struktur muss Klarheit schaffen, statt Tempo zu nehmen. Viele Scale-Ups bauen sich schleichend Komplexität auf, die sie später selbst ausbremst. Entscheidend ist, dass Gründer sich mitentwickeln und ihr eigenes System immer wieder hinterfragen. Ohne Widerspruch entsteht schnell eine Echokammer. Agilität bleibt, wenn jemand regelmäßig stört, Fragen stellt und Entscheidungen schärft. Am Ende gilt: Nicht weniger Prozesse machen agil, sondern die richtigen.

77 % der Befragten haben ihr Geschäftsmodell im letzten Jahr grundlegend hinterfragt. Ist eine permanente „positive Paranoia“ heute die einzige Überlebensstrategie?

Dr. Jenkis: Schon 1996 schrieb der Intel-Mitgründer Andy Groove sein Buch mit dem Titel „Only the Paranoid survive“. Ich würde es eher Wachsamkeit nennen. Erfolgreiche Gründer entwickeln schnell ein feines Gespür dafür, wann sich etwas verändert. Sie hinterfragen sich regelmäßig, ohne sich ständig neu zu erfinden. Das ist ein kontinuierlicher Lernmodus. Wer bestehen will, braucht die Fähigkeit, Stabilität und Bewegung gleichzeitig zu organisieren. Das war schon immer so, ist in der schnelllebigen Wirtschaftswelt von heute aber noch wichtiger.

21 % nutzen bewusst externe Impulse und Netzwerke, um Stillstand zu überwinden. Warum ist das „Schmoren im eigenen Saft“ für junge Unternehmen gefährlicher als jede(r) Wettbewerber*in?

Dr. Jenkis: Weil es die Wahrnehmung verengt. Wenn man nur mit Menschen spricht, die ähnlich denken, entstehen schnell Echokammern. Ideen klingen in der eigenen Blase immer besser, als sie wirklich sind. Risiken werden ausgeblendet, blinde Flecken übersehen. Externe Impulse dagegen bringen Reibung. Und genau diese Reibung sorgt für Klarheit. Wer mit offenen Augen und Ohren durch die Welt geht, sich für Neues begeistert und sich bewusst von anderen – etwa Mentoren oder Sparringspartnern – hinterfragen lässt, entwickelt sich weiter. Wettbewerb fordert von außen. Selbstüberschätzung entsteht von innen.

Im „Museum des Scheiterns“ Ihrer Befragten hängen eher leise Fehlentscheidungen wie unpassende Teams oder kulturelle Blockaden. Was ist die wichtigste Lektion, die Gründende aus diesen strukturellen Fehlern ziehen können?

Dr. Jenkis: Erfolg entscheidet sich selten an der Idee. Vielmehr sind es die Menschen und ihre Art, wie sie zusammenarbeiten. Denn die meisten Probleme entstehen nicht spektakulär, sondern schleichend. Falsche Besetzungen, unklare Kommunikation, fehlendes Vertrauen. Die wichtigste Lektion ist deshalb: Organisation und Kultur sind keine Nebenthemen. Sie sind der Kern unternehmerischen Erfolgs. Darum hier nochmal die klassischen Zitate von Peter Drucker und Safi Bahcall: „Culture eats strategy for breakfast. Structure eats culture for lunch.“

Zum Abschluss: Sie ziehen in Ihrer Studie einen Vergleich zur historischen Fernfahrt von Bertha Benz und sagen: Die Ideen stehen bereit, aber der Weg muss frei werden. Wenn wir dieses Bild auf heute übertragen: Welche eine strukturelle Weiche muss die Politik jetzt stellen, damit die nächste große Idee in Deutschland endlich freie Fahrt bekommt?“

Dr. Jenkis: Verlässlichkeit. Unternehmer können mit Unsicherheit umgehen. Was sie brauchen, sind klare, stabile Rahmenbedingungen. Wenn Regeln nachvollziehbar sind und auf Freiheiten bieten, Verfahren schnell laufen und Entscheidungen planbar werden, entsteht automatisch mehr Bewegung. Die Ideen stehen bereit. Die Menschen auch. Jetzt geht es darum, die Straße so zu gestalten, dass sie frei bleibt.

Dr. Jenkis, Danke für die spannenden Insights!

Das Interview führte StartingUp-Chefredakteur Hans Luthardt

Vom Notfallknopf zum KI-Begleiter: Patronus sammelt 11 Mio. Euro ein

Das 2020 von Ben Staudt und Tim Wagner gegründete Berliner Start-up Patronus sichert sich eine weitere Mio.-Finanzierungsspritze für seinen digitalen (Notruf-)Assistenten im Smartwatch-Format. Doch im stark umkämpften Senior*innen-Tech-Markt reicht ein schickes Design allein nicht mehr aus. Ein Blick hinter die Kulissen von Geschäftsmodell, Historie und wachsendem Wettbewerb.

Die Idee zu Patronus entstand aus einem klassischen Alltagsproblem, das viele Familien kennen: Gründer Ben Staudt erlebte bei seiner eigenen Großmutter, dass der traditionelle, klobige Hausnotrufknopf statt um den Hals zu hängen, lediglich als „Nachttischdekoration“ fungierte. Gemeinsam mit Mitgründer Tim Wagner rief er daraufhin im Jahr 2020 das Unternehmen in Berlin ins Leben. Vor der Veröffentlichung ihres ersten Produkts im Jahr 2021 führte das Team nach eigenen Angaben über tausend Gespräche mit potenziellen Nutzer*innen. Die zentrale Erkenntnis: Die Ablehnung herkömmlicher Notrufsysteme ist weniger technischer Natur, sondern vielmehr ein Problem der Würde und Stigmatisierung.

Mittlerweile ist das Team auf 70 Mitarbeitende angewachsen. Nachdem das Start-up in der Vergangenheit bereits eine beachtliche 27-Millionen-Euro-Runde abschließen konnte, fließen nun weitere 11 Millionen Euro Wachstumskapital in das Unternehmen. Bei dieser Runde wird das Konsortium von 3TS Capital Partners angeführt. Begleitet wird die Finanzierung von Grazia Equity sowie Bestandsinvestoren wie Singular, Burda Principal Investments, Adjacent, NAP und UVC Partners.

Das Produkt: Hohe Akzeptanz trifft auf KI-Visionen

Das Kernprodukt von Patronus ist eine Smartwatch, die sich optisch bewusst von klassischer Medizintechnik abhebt, verschiedene Farben bietet und wie eine herkömmliche Armbanduhr wirkt. Ausgestattet mit einer integrierten SIM-Karte stellt sie im Notfall auf Knopfdruck eine sofortige Verbindung zu einer hauseigenen, mit Fachpersonal besetzten 24/7-Notrufzentrale her.

Der nutzer*innenzentrierte Ansatz zeigt laut Unternehmenszahlen deutliche Wirkung:

- Während klassische Hausnotrufgeräte laut Studien nur von 14 Prozent der Nutzer*innen durchgehend getragen werden.

- Liegt die tägliche Tragequote der Patronus-Uhr bei 85 Prozent.

- Mittlerweile verzeichnet das Start-up 25.000 aktive Kund*innen.

- Die hauseigene Zentrale hat für diese Nutzer*innen bereits mehr als eine halbe Million Notrufe beantwortet.

- Parallel dazu verbindet eine eigens entwickelte App 50.000 Angehörige mit den Senior*innen, um deren Status – wie den Standort oder ob die Uhr getragen wird – im Blick zu behalten.

Das frische Kapital fließt nun in den weiteren Ausbau der Marktführerschaft im mobilen Notrufsegment sowie in einen neuen Produktbereich: einen KI-Begleiter. Dieser soll als digitaler Assistent direkt am Handgelenk über die Patronus Uhr verfügbar sein. Da 12 Prozent der über 75-Jährigen in Deutschland an einem durchschnittlichen Tag kein einziges persönliches Gespräch führen, soll der Assistent dem Gefühl der Einsamkeit in stillen Stunden entgegenwirken.

Geschäftsmodell, Markt & Wettbewerb

So glänzend die Zahlen der Pressemitteilung wirken, verlangt das Geschäftsmodell im dynamischen AgeTech-Sektor eine differenzierte Betrachtung:

Der demografische Rückenwind: Der Bedarf an digitalen Lösungen für ältere Menschen wächst rasant. In Deutschland leben heute 9,6 Millionen Menschen im Alter von über 75 Jahren, in ganz Europa sind es 47,4 Millionen. Gleichzeitig nimmt die Zahl der pflegenden Angehörigen ab. Ein immer größerer Anteil will allein leben. Laut Destatis leben in Deutschland bereits 43 Prozent der Menschen über 75 Jahre allein.

Abo-Modell und Kassen-Abhängigkeit: Patronus refinanziert sich maßgeblich über ein Abo-Modell. Ein wesentlicher Wachstumstreiber ist dabei der deutsche Gesundheitsmarkt: Bei Vorliegen eines Pflegegrads kann die Pflegekasse die monatlichen Nutzungsgebühren (die Software, SIM-Karte und Leitstelle abdecken) stark bezuschussen. Ohne diese staatlichen Subventionen hätten viele Senioren Schwierigkeiten, die fortlaufenden Service-Kosten zu tragen. Diese Abhängigkeit von gesundheitspolitischen Rahmenbedingungen bleibt ein strukturelles Risiko.

Der harte Hardware-Wettbewerb: Patronus positioniert sich als digitaler Marktführer im mobilen Notrufsegment in Deutschland. Doch die Konkurrenz holt auf. Dedizierte Senior*innen-Smartwatches anderer Anbieter*innen bieten ebenfalls moderne Designs, SIM-Karten, Notruf-Sprachverbindungen und teils automatische Sturzerkennungen an. Zudem dringen Tech-Giganten tief in den Markt ein: Apple Watches verfügen längst über präzise Sturzerkennungen und EKG-Funktionen und werden zunehmend von technikaffinen "Best Agern" adaptiert. Der langfristige Burggraben von Patronus muss daher zwingend in der nahtlosen, stark vereinfachten Software-Integration und der menschlichen Notrufzentrale liegen – die Hardware allein ist auf Dauer austauschbar.

Das ethische Dilemma der KI: Einsamkeit unter älteren Menschen ist ein anerkanntes Gesundheitsrisiko, das die kognitive Leistungsfähigkeit beeinflussen, das Demenzrisiko erhöhen und die Lebenserwartung verkürzen kann. Die Lösung von Patronus, diesem Problem mit einem KI-Begleiter zu begegnen, ist innovativ, aber ethisch sensibel. Altersforscher warnen davor, dass "künstliche" Gespräche den Drang nach echten sozialen Interaktionen mindern könnten. Dass Patronus selbst betont, der KI-Begleiter solle menschliche Nähe nicht ersetzen, sondern nur eine Antwort für Stunden bieten, in denen niemand da ist, ist ein wichtiger Disclaimer. Dennoch muss das Unternehmen in der Praxis beweisen, dass die KI im sensiblen Pflegeumfeld echte Empathie simulieren kann, ohne die Nutzer*innen zu verwirren.

Unser Fazit

Patronus zeigt, wie man durch konsequentes User-Centric-Design einen verstaubten Markt aufbricht und stigmatisierte Produkte salonfähig macht. Die neuen 11 Millionen Euro geben dem Start-up den nötigen Spielraum für technologische Innovationen. Um die hohe Bewertung nachhaltig zu rechtfertigen, muss Patronus künftig jedoch beweisen, dass der Vorstoß in die künstliche Intelligenz ethisch sauber umgesetzt wird und man dem zunehmenden Hardware-Preisdruck der Wettbewerber*innen standhalten kann.

Gründer*in der Woche: Vjus.AI – Vom SEO zum GEO

Wie das 2026 von Wolfe Diener gegründete Start-up Vjus.AI den Kampf um die KI-Sichtbarkeit gewinnen will.

Die Ära der klassischen Suchmaschinenoptimierung (SEO) bekommt ernstzunehmende Konkurrenz. Wenn Nutzer*innen heute nach Produkten oder Dienstleistungen suchen, tippen sie ihre Fragen zunehmend in Dialogfenster von Sprachmodellen statt in traditionelle Suchschlitze. Genau an dieser Schnittstelle positioniert sich das neu gestartete Münchner Start-up Vjus.AI. Doch kann eine Software wirklich die „Black Box“ der generativen KI entschlüsseln – und wie nachhaltig ist das Geschäftsmodell?

Hinter der am 1. April 2026 offiziell gelaunchten Plattform steht die AtWize Business Services GmbH mit Sitz in München. Kopf des Unternehmens ist Gründer Wolfe W. Diener, der zuvor bereits in leitenden Positionen als Geschäftsführer und im Vorstand großer Softwarehäuser aktiv war. Mit dem Start von Vjus.AI vollzieht das Unternehmen nun eine strategische Erweiterung in den stark wachsenden Bereich der Answer Engine Optimization (AEO) und Generative Engine Optimization (GEO).

Vom Humankapital zur KI-Sichtbarkeit

Die Historie des Unternehmens ist dabei von einem interessanten Strategiewechsel geprägt. Ursprünglich startete AtWize 2023 mit einem Fokus auf KI-Lösungen gegen den Fachkräftemangel. Diener erklärt die Hintergründe: „Parallel hatte ich schon eine Weile an der Idee arbeitete, Unternehmen zu ermöglichen, ihre in den Ruhestand ausscheidenden Mitarbeiter strukturierter zu managen, um sie bei Bedarf für Projekte oder übergangsweise anzusprechen. Es liegt so viel Humankapital und Erfahrung brach.“ In der aktuellen wirtschaftlichen Phase sei dies jedoch kein Top-Thema gewesen, weshalb man sich zunächst auf die Software-Entwicklung für Dritte konzentriert habe.

Der eigentliche „Aha-Moment“ kam durch die tägliche Arbeit. „Im letzten Jahr haben wir dann immer mehr auch KI-Tools zur Entwicklung eingesetzt und dabei den Bedarf, sogar die Notwendigkeit erkannt, die Sichtbarkeit in KI-Modellen zu messen und zu verbessern“, so Diener. Die Dringlichkeit begründet er mit dem veränderten Nutzer*innenverhalten: „KI-Modelle geben begründete Empfehlungen zur gestellten Frage. Da sucht man nicht weiter, sondern nimmt das Ergebnis wie es ist. Wer da nicht enthalten ist, ist unsichtbar.“

Nutzer*innensimulation: Die reale Perspektive

Vjus.AI setzt auf die Simulation realer Suchanfragen. Während klassische SEO-Tools oft auf APIs zugreifen, misst diese Plattform, wie Marken in Antworten von ChatGPT, Gemini, Grok oder Perplexity tatsächlich erscheinen. Auf die Frage nach der technischen Umsetzung und der Nicht-Deterministik der KI-Modelle antwortet Diener detailliert: „Wenn Sie Ihre Sichtbarkeit bei KI-Suchen wissen wollen, dann sollte diese ja so gemessen werden, wie sie ein normaler Nutzer, der einem KI-Modell eine Frage stellt, einen Prompt eingibt, auch sieht.“ Man müsse also zunächst Prompts definieren, bei denen man gefunden werden wolle – etwa als Münchner Zahnarzt bei der Frage nach dem besten Zahnarzt vor Ort.

„Wir analysieren die Ergebnisse, die von den KI-Modelle auf die Prompts hin geliefert werden“, erklärt Diener weiter. Dabei werden Kennzahlen wie Sichtbarkeit, Ranking und Sentiments (neutrale, positive oder negative Notation) erhoben. Den Vorwurf einer verzerrenden technischen Schicht weist er zurück: „Wir sind insofern keine Zwischenschicht, sondern werten die Daten aus, die viele User auch sehen würden. Die Nicht-Deterministik führt dabei zwar zu kleinen Schwankungen, aber es entsteht insgesamt ja ein Bild über die Zeit.“

Marktchancen und der „Unfair Advantage“

Das Interesse am Markt scheint groß zu sein; bereits vor dem offiziellen Launch konnten erste Kund*innen gewonnen werden. Finanziell steht das Start-up auf eigenen Beinen: „Wir finanzieren uns komplett aus eigenen Mitteln. Und da wir schon Kunden im Entwicklungsbereich haben, konnten wir Vjus.AI früh anwenden und testen“, betont der Gründer. Mit Investor*innen habe man noch nicht gesprochen: „Jetzt erst mal machen, dann reden wir.“

Um sich gegen die großen SEO-Platzhirsche zu behaupten, setzt Diener auf vier spezifische technische Vorteile. Erstens setze man auf eine natürliche Simulation: „Unsere Art des Promptens simuliert wirklich natürliche User. Andere machen das nicht.“ Zweitens komme eine eigene Scraping-Technologie zum Einsatz. Diese erlaube eine besonders detaillierte Analyse der Ergebnisse, auch der „Nebengeräusche“ wie etwa Quellenangaben. Als dritten Punkt nennt der Gründer das analytische Prompting: Vjus.AI unterstützt nicht nur beim Erstellen von Prompts, sondern analysiert auch, wie passend diese für die Sichtbarkeitsmessung sind. Viertens biete das Improver-Modul ein Analyse-Tool, das über die Daten hinweg ermittelt, „was die Haupthebel für das Unternehmen oder die Marke ist, um die Sichtbarkeit bei KI-Suchen zu erhöhen“.

GEO als neues Standard-Tool?

Für die Zukunft sieht Diener eine klare Entwicklung. Zwar werde es in zwei Jahren wahrscheinlich immer noch die klassische Google-Suche geben, doch der Übergang sei bereits fließend, da Google zunehmend KI-Ergebnisse mitliefere. „Die Suche mit KI-Modellen wird aber die gewohnte Praxis werden“, ist sich Diener sicher.

Seine Prognose für die Branche ist deutlich: „Insofern wird SEO eher übergehen in ein GEO. Ein SEO ohne Beachtung der Optimierungen für KI-Modelle macht aus meiner Sicht aber heute schon keinen Sinn mehr.“ Das Ziel für Vjus.AI ist dabei klar gesteckt. Die größte Hürde sei es, für die Nutzer*innen den besten Mehrwert zu generieren: „Darauf liegt unser Fokus und deshalb rennen wir, so schnell wir können.“

Vom Assekuradeur zum Cyber-Abwehrzentrum: Baobabs riskante Wette auf die All-in-One-Lösung

Es ist ein mutiger Schritt für ein junges Unternehmen: Das 2021 in Berlin gegründete InsurTech Baobab Insurance streift sein reines Versicherungs-Image ab und firmiert ab sofort unter dem Namen Baobab Risk Solutions (BRS). Zeitgleich führt das Start-up einen eigenen Managed Detection and Response (MDR) Service ein. Damit will das Unternehmen künftig nicht mehr nur den finanziellen Schaden bei Cyberangriffen abfedern, sondern die Angriffe selbst aktiv abwehren. Ein ambitionierter Plan, der das Geschäftsmodell unter enormen Leistungsdruck setzt.

„Unser neuer Name ist ein Versprechen an den Markt: Wir bieten keine bloßen Policen, sondern eine ganzheitliche Strategie gegen digitale Risiken“, erklärt Mitgründer und Geschäftsführer Vincenz Klemm. Prävention, Abwehr und Versicherung sollen fortan eine untrennbare Einheit bilden. Auf die Vermutung, das reine Versicherungsgeschäft sei für den Mittelstand schlichtweg zu unprofitabel geworden, kontert der Gründer deutlich: „Der Wechsel zu Risk Solutions ist weit mehr als ein neues Branding. Damit lösen wir unser Gründungsversprechen konsequent ein.“ Die bloße Police sei nie das Endprodukt gewesen, der Schritt zum aktiven Abwehrdienstleister sei von Tag eins an auf der Roadmap gestanden. Klemm fasst die neue Ausrichtung in einem klaren Kernsatz zusammen: „Wir warten somit nicht darauf, dass ein Schaden reguliert werden muss. Wir sorgen stattdessen aktiv dafür, dass er gar nicht erst entsteht.“ Dies sei kein Ausstieg aus der Versicherung, sondern die Evolution zum echten Risikomanagement für den Mittelstand und Industrieunternehmen.

Vom Millionen-Exit zum Cyber-Schutzschild

Um die Ambitionen von Baobab Risk Solutions zu verstehen, lohnt ein Blick auf das Gründer-Duo. Vincenz Klemm (Geschäftsführer) und Anton Foth (CTO) bringen geballte Erfahrung mit. Klemm baute in den USA den digitalen Makler Gabi auf und verkaufte ihn für rund 320 Millionen US-Dollar an Experian, während Foth als ehemaliger CTO von Coya (später Luko) die tiefe technische Expertise für datengetriebene Versicherungsmodelle liefert. Gestartet mit rund 4,2 Millionen US-Dollar Pre-Seed-Kapital, ist das Unternehmen mittlerweile in Deutschland, Österreich und den Benelux-Ländern aktiv.

Der Aufbau eines europäischen Assekuradeurs in den vergangenen fünf Jahren verlief dabei nicht ohne Hürden. „Eine europäische Expansion ist niemals eine reine Blaupause“, räumt Klemm ein. Um regulatorische Fallstricke frühzeitig zu erkennen, setze man gezielt auf lokale Expertise wie den General Manager für die Benelux-Staaten, Tim van Lier. Als größten Trumpf sieht Klemm jedoch die eigene Reaktionsgeschwindigkeit: „Wenn etwas nicht funktioniert, korrigieren wir es binnen Tagen, statt in monatelangen Release-Zyklen zu verharren.“ Auch die Frage nach frischem Kapital für den nun extrem kostenintensiven MDR-Betrieb wischt er routiniert beiseite: Man sei durch die letzte Finanzierungsrunde hervorragend aufgestellt. Sollte man dennoch nachlegen müssen, wisse man Investoren an der Seite, die „bei positiven Trends extrem schnell Kapital mobilisieren können.“

Der neue Vorstoß: MDR und ein 24/7-Defense-Center

Die Argumente für den neuen, zubuchbaren MDR-Service stützen sich auf drastische Marktveränderungen. Laut dem CrowdStrike Global Threat Report 2026 erfolgen 82 Prozent aller Angriffe mittlerweile ohne klassische Schadsoftware, woran Standard-Antivirus-Programme oft scheitern. Baobabs Antwort darauf ist ein rund um die Uhr besetztes Security Operations Center (SOC). Die Ansagen des Start-ups sind selbstbewusst: Mit einer Erkennungsrate von 99 Prozent identifiziere man Bedrohungen bereits in der Entstehungsphase. Die hauseigene Deep-Scan-Technologie arbeite 3,2-mal effektiver als herkömmliche Scans, zudem liege die Angriffsfrequenz bei Bestandskund*innen um 77 Prozent unter dem Marktdurchschnitt. Ergänzt wird das Ganze durch Dark Web Monitoring.

Doch wie kann ein Start-up im Angesicht des globalen Fachkräftemangels in der Cybersecurity personell und technologisch mit staatlich finanzierten Hacker-Syndikaten mithalten? Klemm verweist auf das ambitionierte Umfeld: Weil das Team Kunden aktiv berate und nicht nur stumpf Risiken überwache, habe man sich als Top-Adresse für Talente etabliert. Gleichzeitig gibt er sich pragmatisch und räumt ein, dass man nicht alles allein stemmen kann: „Um personelle Spitzen abzufangen, kooperieren wir mit hochprofessionellen Technologiepartnern.“ Diese Hybridstrategie sichere die Skalierbarkeit und den Zugang zu führender Technologie. Das absolute Kernversprechen an den Kunden tastet er dabei jedoch nicht an: „Die Analyse und der direkte Kontakt bleiben immer bei uns.“

Genial verzahnt oder überhoben?