Aktuelle Events

Step-by-Step zum eigenen Podcast

Von der Planung bis zum Publishing deines Unternehmens-Podcasts: Wir zeigen die wichtigsten Erfolgsfaktoren und größten Fallstricke.

Podcasts haben sich in den letzten Jahren zu einem wichtigen Kommunikationsmedium entwickelt und gewinnen auch als Marketinginstrument im Unternehmenskontext immer mehr an Bedeutung. Sie bieten die Möglichkeit, Wissen und Expertise zu teilen, die Markenbekanntheit zu steigern und nicht zuletzt auch eine tiefere Verbindung zur Zielgruppe sowie zu potenziellen Mitarbeitenden aufzubauen.

Anders als viele Unternehmen glauben, eignen sie sich gerade nicht nur für Endkund*innenthemen, sondern sind gerade auch im B2B-Umfeld und in Branchen mit komplexen, nicht so leicht zu erklärenden Produkten und Dienstleistungen ein gutes Mittel der Kund*innenkommunikation. Nicht zuletzt eröffnet ein Unternehmens-Podcast (im Folgenden kurz Podcast) auch Potenzial beim Employer Branding und kann dazu beitragen, dem Fachkräftemangel entgegenzuwirken.

Doch was genau muss vor dem Start der Produktion eines Podcasts bedacht werden? Wie startet man ein solches Format? Und noch viel wichtiger: Wie hält man die Produktion langfristig durch und sorgt mit einer stringenten Vermarktung für organisches Wachstum bei den Hörer*innenzahlen?

Dieser Beitrag gibt einen umfassenden Überblick über die Schritte von der Planung bis zum Publishing und erläutert die Erfolgsfaktoren und Fallstricke.

Konzept und Zielsetzung: Passende Zielgruppenansprache ist entscheidend

Der erste Schritt bei der Erstellung eines Podcasts ist die Konzeptentwicklung und Zielsetzung. Unternehmen müssen in Kooperation mit Marketingleitung und Geschäftsführung festlegen, was sie damit konkret erreichen möchten – sei es die Stärkung der Markenbekanntheit, die Generierung von Leads oder Kund*innenbindung. Und sie sollten, am besten mithilfe entsprechender Personas, definieren, für wen sie das passende Format entwickeln. Eine präzise Zielgruppenanalyse ist hierfür ebenso unerlässlich wie das Verständnis dafür, dass Themen unterschiedlich in Formatwahl, Länge, Tonalität und Zielgruppenansprache angegangen werden können.

Bei der Formatwahl kann eine Mischung aus beispielsweise Interview, Solofolgen und Paneldiskussionen gewählt werden; wichtig ist die jeweils passende Herangehensweise an ein Thema, die das Unternehmen und seine Produkte vorteilhaft und kompetent erscheinen lässt. Nicht zuletzt ist ein einprägsamer und beschreibender Name für den Podcast wichtig, der Einzigartigkeit und Relevanz transportiert und die Marke optimal repräsentiert. Dieser sollte im besten Fall SEO-seitig gut zu bespielen sein.

Gründliche Planung und Vorbereitung sind entscheidend für den Erfolg eines Podcasts, ein Kick-off-Workshop und regelmäßige Themen-Meetings sind hierfür unerlässlich.

Der oder die Verantwortliche sollte eine Aufgabenteilung anstreben, die im Vorfeld Daten für Gästeansprache, Aufnahme, Postproduktion und Marketing sowie Publikation vorsieht – und mit Blick auf Urlaube und andere Abwesenheiten sollte für jedes Gewerk auch ein(e) Vertreter*in benannt sein, der oder die mit den grundlegenden Workflows vertraut ist.

Zunächst sollte eine Themenplanung vorgenommen werden, die mindestens die ersten sechs Monate umfasst, die dann jeweils für drei weitere Monate im Voraus plant und agil angepasst werden kann. Sinnvoll ist es dabei, Unternehmensereignisse wie anstehende Messen und Konferenzen sowie Produktlaunches und Saisonalitäten zu berücksichtigen. Für den Erfolg entscheidend ist aber auch, den Podcast nicht als Zweitverwertung oder Recyclingplattform zu verstehen, sondern „unique“ und exklusive Inhalte primär dafür zu produzieren. Bewährt hat sich in vielen Unternehmen auch die Herangehensweise, ein Thema erst inhaltlich zu entwickeln und in einem zweiten Schritt zu entscheiden, ob es Podcast-tauglich aufbereitet werden kann.

Für jede Podcast-Folge sollte eine klare Struktur und ein zumindest grober Ablauf festgelegt werden, um Konsistenz zu gewährleisten. In diesem Zusammenhang wird sich übrigens schnell herausstellen, ob die angedachte Frequenz sinnvoll und machbar oder zu ambitioniert ist. Klug ist es, mehrere Episoden im Voraus aufzunehmen, um eine kontinuierliche Veröffentlichung sicherzustellen und auf möglichst verlässliche Veröffentlichungstermine (etwa jeden ersten Freitag im Monat) zu setzen. Ein verbindlicher Veröffentlichungsplan ist wichtig, um regelmäßig neuen Content zu liefern – und weil die Hörer*innen im besten Fall schon auf die neue Folge warten.

Produktion und Technik: Einfache Handhabung und gute Qualität überzeugen

Eine hochwertige Ausrüstung, also gute Mikrofone und Kopfhörer, sowie eine geeignete Aufnahmesoftware und gegebenenfalls ein Mehrspurrecorder sind essenziell für eine hohe Audioqualität. Und die ist vor allem deswegen entscheidend, weil Podcasts meist nah am Ohr gehört werden. Professionelles Equipment ist gar nicht so teuer und komplex in der Handhabung. Bei der Auswahl bieten sich große Musikhändler*innen an, die meist über das nötige Know-how und die Beratungskompetenz rund um Aufnahmetechnik verfügen.

Als Software eignet sich unter anderem das seit Jahren bewährte Freeware-Tool Audacity (für Windows) oder die bei Apple kostenfrei erhältliche Garage Band (für Mac). Diese Tools sind intuitiv in der Handhabung und gerade für den Anfang gut geeignet, weil sie alle fürs Podcasting relevanten Features besitzen. Aufwendigere und teure Schnittprogramme wie Adobe Audition und Reaper sind im Hinblick auf den Funktionsumfang und die Filter einen Blick wert; die Programme Ultraschall und Hindenburg Pro sind speziell auf die Bedürfnisse von Pocaster*innen zugeschnitten.

Wer Remote aufzeichnet, also die Gesprächspartner*innen an unterschiedlichen Orten sitzen hat, sollte im Hinblick auf die Tonqualität nicht auf eine Konferenzsoftware wie Zoom oder Teams setzen – auch weil dann lediglich eine Spur produziert wird, was die Postproduktion erschwert. Dienste wie Zencastr, Riverside.fm, Waveroom oder Studio-Link zeichnen hingegen lokal einzelne Spuren auf und führen diese erst im Nachgang in einer Cloud zusammen. Das erleichtert einerseits die Angleichung der Lautstärke zwischen den einzelnen Sprecher*innen und hilft andererseits bei der Qualitätsoptimierung in der Postproduktion.

Doch Professionalität ist nicht nur bei der Tonqualität, sondern auch bei den Sprecher*innen wichtig. Auch wenn man als Host für einen Podcast keine Sprecher*innenausbildung benötigt und (leichte) Dialektfärbung oder Akzent überhaupt nicht schadet, sollten Moderator*innen und Sprecher*innen auf Atemtechnik, Tempo (nicht zu schnell und nicht ablesen) sowie Aussprache und Satzmelodie achten. Sprechen im aufrechten Stehen schafft mehr stimmliches Volumen und wirkt selbst beim Hören souveräner.

Die Aufnahmeumgebung sollte ruhig und frei von Hintergrundgeräuschen sein, also möglichst wenig ablenkende Rauminformationen haben. Hier sollte auf unauffällige Raumakustik geachtet werden, die sich mithilfe von Akustikabsorbern und Noppenschaumstoffelementen optimieren lässt. Die Produktion eines Podcasts sollte im besten Fall „live on tape“ durchgeführt werden, sodass im Nachgang möglichst wenig geschnitten werden muss und die Dialoge dennoch lebendig wirken. Vorab durchgeführte Tests helfen, die optimale Audioqualität sicherzustellen. In der Bearbeitung sollten Füllwörter und Pausen herausgeschnitten sowie gegebenenfalls Musik und Jingles hinzugefügt werden. Ein einheitliches In- und Outro, das die Marke widerspiegelt, begrüßt und verabschiedet die Zuhörer*innen und sorgt für einen professionellen Rahmen für jede Episode.

Branding und Marketing: Konsistentes Konzept mit Wiedererkennungswert

Ein konsistentes audio-visuelles Konzept ist wichtig für den Wiedererkennungswert des Podcasts. Logos und Designelemente sollten ebenso wie Jingles und Musikelemente auf allen Plattformen einheitlich verwendet werden. Dabei macht es im Hinblick auf Kosten und im Interesse der Professionalität oftmals Sinn, solche dedizierten Teilgewerke an einen professionellen Dienstleister auszulagern, der solche SounddesignElemente regelmäßig erstellt und ein gutes Ergebnis in einem Bruchteil der Zeit hinbekommen wird.

Eine durchdachte Marketingstrategie hilft dabei, den Podcast bekannt zu machen und eine Audience aufzubauen. Für das Marketing eignen sich die bestehenden Social-Media-Präsenzen und Newsletter, aber natürlich auch die Unternehmenswebsite und andere Kanäle. Partnerschaften oder Sponsoring können die Reichweite des Podcasts ebenso erhöhen wie gut vernetzte Mitarbeitende des Unternehmens, die zu Markenbotschafter*innen via LinkedIn und Co. werden. Unternehmen sollten zudem prüfen, ob Kooperationen sinnvoll sind und wie sie am besten umgesetzt werden können.

Distribution und Monitoring: Auf die Community kommt es an

Ein Podcast wird entweder auf jeder Distributionsplattform einzeln hochgeladen oder mithilfe einer Podcast-Hosting-Plattform wie Podigee, Podbean, Letscast.fm oder Spotify for Podcasters bereitgestellt. In diesem Fall fungiert die Hosting-Plattform als Basis und die Podcast-Episoden werden über einen RSS-Feed verteilt, der auf verschiedenen Plattformen wie Spotify oder Apple Podcasts mit einer Feed-Adresse registriert wird.

Unternehmen sollten auf die dort mögliche Community-Pflege achten, also entsprechendes Feedback der Hörer*innen berücksichtigen. Denn Zuhörer*innenfeedback ist wertvoll. Unternehmen sollten aktiv um Rückmeldungen bitten und basierend auf diesem Feedback Anpassungen vornehmen. Analyse-Tools der Podcast-Plattformen helfen, Zuhörer*innenzahlen, Downloads und Engagement zu messen. Links sollten mit Link-Shortening-Anbieter*innen verkürzt und mit UTM-Parametern versehen werden, um den Erfolg besser messen zu können.

Basierend auf den gesammelten Daten und dem Feedback sollten Inhalte, Strategie und Veröffentlichungsplan kontinuierlich angepasst werden, um den Erfolg des Podcasts langfristig zu sichern. Auch wenn Podcasts vor allem von Stammhörer*innen gehört werden, kann die Optimierung der Beschreibungen mit relevanten Keywords die Auffindbarkeit verbessern. Auch die Nutzung von Hashtags kann dabei helfen, eine größere Zielgruppe zu erreichen.

Dennoch sind bei einem Podcast die Hörer*innenzahlen nicht ansatzweise mit denen eines populären Comedy-Formats oder „Laber-Podcasts“ vergleichbar – und die Zahlen im deutschsprachigen Raum aufgrund der Sprachbegrenzung auch nicht mit denen anderer Länder. Achte also darauf, dass du nicht Äpfel mit Birnen vergleichst. Umgekehrt heißt das aber, dass man durchaus auf Best Practice Cases aus vergleichbaren Branchen- und Markenumfeldern schauen kann, um sich beim Handwerkszeug einiges abzuschauen – etwa im Hinblick auf Kooperationen oder Brand Influencer*innen. Im Rahmen des Monitorings zeigt sich auch, welche aktuellen saisonalen Inhalte und Branchenthemen gut funktionieren.

Das Potenzial des Unternehmens-Podcasts nutzen und ausbauen

Podcasts bieten Unternehmen eine wertvolle Möglichkeit, ihre Marke nachhaltig mit Content zu stärken, Wissen zu teilen und eine tiefere Verbindung zur Zielgruppe aufzubauen. Mit einer sorgfältigen Planung, qualitativ hochwertiger Produktion und gezieltem Marketing kann ein Podcast zu einem erfolgreichen Kommunikationsinstrument werden. Doch all das erfordert gerade angesichts der wachsenden Konkurrenz einen langen Atem. Durch kontinuierliches Monitoring und Optimierung lässt sich der Erfolg langfristig sichern und ausbauen, wobei ein(e) externe(r) Berater*in wertvolle Insights bringen kann. Ein gut gemachter Podcast ist somit nicht nur ein Trend, sondern ein nachhaltiges Werkzeug in der modernen Unternehmenskommunikation.

Der Autor Eric Hinzpeter ist Content-Marketing-Experte bei Smarketer. Das Unternehmen ist im Bereich Performance Marketing in der DACH-Region tätig und unterstützt Unternehmen bei der Entwicklung professioneller Strategien für Google Ads und Microsoft Advertising Services.

Diese Artikel könnten Sie auch interessieren:

Stallgrün: Mit Hightech-Kräutern gegen den Agrar-Strukturwandel

Leere Ställe als Chance: das 2023 von Judith Ryll und Thorsten Lansmann-Niehaus gegründete Stallgrün nutzt Bestandsbau für Indoor Farming. Wir checken das Modell hinter der aktuellen 125.000-€-DBU-Förderung.

Der Strukturwandel in der deutschen Landwirtschaft ist unaufhaltsam: Allein zwischen 2013 und 2023 ging die Zahl der hiesigen Betriebe mit Schweinehaltung um 44 Prozent zurück, wie Zahlen des Bundesministeriums für Ernährung und Landwirtschaft (BMEL) belegen. Jedes Jahr geben Landwirt*innen auf. Zurück bleiben leere Ställe – und Landwirtschaftsbetriebe auf der Suche nach neuen finanziellen Perspektiven.

Das 2023 in Münster gegründete Start-up Stallgrün will aus diesen „Stranded Assets“ einen lukrativen Zukunftsmarkt formen: Indoor Farming im ehemaligen Schweinestall. Die Deutsche Bundesstiftung Umwelt (DBU) unterstützt das Projekt aktuell mit 125.000 Euro im Rahmen ihrer Green Startup-Förderung. Wir wollten wissen: Wie tragfähig ist das Modell jenseits der Fördergelder wirklich?

Die Köpfe hinter der Idee & die Historie

Hinter Stallgrün stehen die Gründer Judith Ryll und Thorsten Lansmann-Niehaus. Ryll bringt als Biowissenschaftlerin tiefe Expertise in der Pflanzenbiologie mit, während Lansmann-Niehaus – der bezeichnenderweise selbst auf einem Schweinemastbetrieb aufwuchs – die kaufmännische Führung übernimmt. Gefördert durch regionale Inkubatoren wie das Seedhouse, hat das Duo den technologischen Machbarkeitsnachweis bereits erbracht: In den vergangenen zwei Jahren wurde das Konzept auf einer Pilotfarm erfolgreich entwickelt.

Das Geschäftsmodell: Mehr als nur Hardware

Die Grundprämisse ist so simpel wie pragmatisch: Ehemalige Schweineställe sind in der Regel massiv gebaut sowie gut isoliert und bieten damit architektonisch ideale Bedingungen für den ganzjährigen Anbau von regionalen Kräutern und Gemüse. Stallgrün positioniert sich als B2B-Technologie- und Service-Provider für Höfe im Wandel und will deutschlandweit agieren. Das System fußt auf drei wesentlichen Säulen:

- Automatisierte Anlagentechnik: Als Kernprodukt hat das Start-up während der DBU-Förderung eine Anlage entwickelt, welche die Bewässerung, Düngung, Belichtung und Klimatisierung automatisiert steuert.

- Datengetriebene Agrar-Software: Ergänzend liefert das Team spezifische Anbauprotokolle für die teilnehmenden Betriebe. Für geeignete Kulturen wurde der optimale Einsatz von Parametern wie Saatgut, Erde, Dünger, Licht und Bewässerungszyklen definiert.

- B2B-Ökosystem: Um die Einstiegshürde zu minimieren, hat Stallgrün einen Materialhandel für passendes Anbaumaterial aus einer Hand aufgebaut und bietet rechtliche Hilfen bei der Verwaltung an. Zudem unterstützt das Start-up beim Aufbau der Vermarktung.

Stallgrün versteht sich dabei nicht als Feind der traditionellen Landwirtschaft. Laut Lansmann-Niehaus ist Indoor Farming kein Ersatz für den etablierten Freiland- oder Gewächshausanbau, sondern eine wetter- und klimaunabhängige Ergänzung.

Die Vision: Produkte sollen ganzjährig regional verfügbar gemacht werden. Die vermehrte Nutzung regionaler Lebensmittel anstelle von Importen reduziere zudem den Transportaufwand und die daraus entstehenden Emissionen.

Kritische Markteinordnung

Der Markt für Vertical- und Indoor-Farming ist ein hartes Pflaster. Prominente Branchenvorreiter wie das ehemals hochgelobte Berliner Start-up Infarm haben in der Vergangenheit massiv Risikokapital verbrannt, weil die schiere Skalierung von energieintensiven Hightech-Farmen in urbanen Ballungsräumen betriebswirtschaftlich oft zum Scheitern verurteilt war.

Hier liegt der geniale, aber auch kritische Hebel von Stallgrün: Anstatt teure Gewerbeimmobilien anzumieten, nutzt das Team bestehende, ländliche Infrastruktur. Das verhindert eine zusätzliche Versiegelung von Flächen, was auch DBU-Generalsekretär Alexander Bonde als zentralen ökologischen Faktor hervorhebt. Ein weiterer Wettbewerbsvorteil: Viele Höfe verfügen bereits über großflächige Photovoltaikanlagen auf ihren Stalldächern. Damit lässt sich der enorme Strombedarf für die Belichtung und Klimatisierung teilweise direkt durch eigenen, günstigen Sonnenstrom abdecken.

Dennoch bleiben aus unserer Sicht drei gravierende Hürden für das Geschäftsmodell:

- CAPEX-Intensität: Die Umrüstung eines leeren Stalls in eine funktionsfähige Hightech-Anlage ist extrem kapitalintensiv. Es bleibt fraglich, wie Landwirte, die gerade aus der unprofitablen Schweinehaltung ausgestiegen sind, das nötige Investitionskapital für diesen Hardware-Neustart bei ihren Banken abrufen können.

- Radikaler Kulturwandel: Einen traditionellen Schweinemäster in einen agilen, datengetriebenen Indoor-Kräuterproduzenten zu transformieren, erfordert enormen Beratungs- und Change-Management-Aufwand seitens Stallgrün.

- Wettbewerb & Margendruck: Die teilnehmenden Bauern und Bäuerinnen kämpfen letztlich gegen die extrem knappen Margen des Lebensmitteleinzelhandels.

Unser Fazit

Stallgrün liefert einen erfrischend bodenständigen „Hardware-meets-Agrar“-Ansatz in einem Tech-Segment, das lange Zeit von utopischen, rein urbanen Vertical-Farming-Träumereien dominiert wurde. Durch die kluge Umnutzung von Infrastruktur-Altlasten und die clevere Kombination aus Hardware, Software-Protokollen und einem integrierten B2B-Serviceangebot hat das Duo ein System aufgebaut, das ein hohes Skalierungspotenzial besitzt.

Die DBU-Förderung von 125.000 Euro ist ein sauberes Validierungssignal für den positiven ökologischen Impact der Gründer*innen. Die wahre Reifeprüfung wird nun jedoch in den Bilanzen der kooperierenden Landwirte stattfinden: Nur wenn die Höfe durch den automatisierten Anbau zügig ihre hohen Anfangsinvestitionen amortisieren können, wird aus dem Münsteraner Pilotprojekt ein neuer bundesweiter Agrar-Standard. Ein mutiger Pivot für die heimische Landwirtschaft – und ein Start-up, das man als Investor*in und Beobachter*in der Agrar-Wende unbedingt auf dem Zettel haben sollte.

Versandlogistik für E-Commerce-Gründer

Erfahren Sie, worauf Gründer im E-Commerce in Bezug auf die Versandlogistik achten sollten.

Viele E-Commerce-Gründer investieren vor dem Shop-Launch viel Zeit in Produktentwicklung, Shopdesign und Marketing. Die Versandlogistik wird dagegen oft unterschätzt – obwohl sie bereits in den ersten Monaten direkten Einfluss auf Kosten, Kundenbewertungen und Retourenquoten hat.

Gerade Verpackungen entwickeln sich schnell zum versteckten Kostenfaktor. Zu große Kartons erhöhen die Versandkosten, schlechte Polsterung führt zu Reklamationen und unnötig aufwendige Verpackungen wirken weder nachhaltig noch professionell. Wer früh sinnvolle Standards definiert, spart langfristig Zeit und Geld. Die folgenden Abschnitte enthalten hierzu einige Tipps.

Die richtige Kartongröße spart mehr Geld als viele denken

Viele Gründer starten mit wenigen Standardkartons „von der Stange“. Das funktioniert am Anfang zwar pragmatisch, wird aber schnell teuer.

Versanddienstleister wie DHL kalkulieren Preise nicht nur nach Gewicht, sondern auch nach Paketmaßen. Bereits leicht überdimensionierte Sendungen können in höhere Versandklassen fallen. Besonders problematisch wird das, wenn kleine Produkte in viel zu großen Kartons verschickt werden.

Ein typisches Beispiel: Ein Produkt mit 120 × 80 × 40 mm landet in einem Karton mit 400 × 300 × 200 mm. Dadurch steigen nicht nur die Versandkosten, sondern auch der Bedarf an Füllmaterial.

Für viele kleinere Artikel reichen Größen wie 200 × 150 × 90 mm oder 250 × 200 × 120 mm völlig aus. Wer Versandkartons in passender Größe auswählt und früh mit standardisierten Größen arbeitet, kann Lager- und Versandkosten deutlich besser kontrollieren. In der Praxis ist es sinnvoll, zu Beginn mit drei bis fünf Standardgrößen zu arbeiten. Das vereinfacht Lagerung, Einkauf und Verpackungsprozesse deutlich.

Wichtig ist außerdem, die Entwicklung des eigenen Sortiments im Blick zu behalten. Viele Shops erweitern ihr Portfolio bereits nach wenigen Monaten. Dann sollte auch das Verpackungssystem angepasst werden.

Einwellig oder doppelwellig? Warum die Kartonqualität wichtig ist

Viele Gründer achten beim Kartoneinkauf zuerst auf den Preis. Dabei spielt die Stabilität eine entscheidende Rolle.

Im E-Commerce kommen vor allem einwellige und doppelwellige Kartons zum Einsatz. Einwellige Varianten wie 1.30B eignen sich für leichte Produkte wie Kleidung, Kosmetik oder kleinere Accessoires. Sie sind günstiger und platzsparender.

Doppelwellige Kartons wie 2.30BC bieten dagegen deutlich mehr Stabilität. Sie eignen sich für empfindliche oder schwerere Produkte sowie längere Transportwege. Wer Technik, zum Beispiel Smarthome Lösungen, wie sie unter anderem auf den Seiten von homeandsmart immer wieder vorgestellt werden, Glaswaren oder schwere Einzelprodukte verschickt, sollte eher auf doppelwellige Lösungen setzen.

Ganz wichtig: Polstermaterial richtig einsetzen

Auch beim Füllmaterial machen viele Einsteiger typische Fehler.

Zu wenig Polsterung führt schnell zu beschädigten Produkten. Zu viel Verpackungsmaterial wirkt dagegen unprofessionell und erhöht die Kosten unnötig. Kunden reagieren inzwischen zudem sensibel auf übertriebene Plastikverpackungen und wissen es zu schätzen, wenn ein Start-up zum Beispiel nachhaltig ist.

In der Praxis gilt deshalb: so kompakt wie möglich, aber so sicher wie nötig.

Papierpolster oder Recyclingmaterial wirken heute meist hochwertiger als große Mengen Kunststofffüllung. Wichtig ist außerdem, dass Produkte im Karton möglichst wenig Spielraum haben. Bereits einfache Falltests helfen dabei, die Verpackung realistisch zu prüfen.

Gerade bei zerbrechlichen Produkten lohnt es sich, mehrere Verpackungsvarianten zu testen, bevor größere Mengen bestellt werden.

Bestellmengen realistisch planen: So geht’s!

Viele Gründer bestellen ihre ersten Kartons entweder viel zu knapp oder direkt palettenweise.

Beides kann problematisch werden. Kleine Mengen verursachen oft hohe Stückpreise und ständigen Nachbestellaufwand. Zu große Bestellungen blockieren dagegen Lagerfläche und binden Kapital.

Gerade in den ersten zwölf Monaten verändern sich Sortiment und Versandzahlen häufig schneller als erwartet. Deshalb solltest Du zunächst eher konservativ planen. Für viele kleine Shops sind Verpackungsbestände für zwei bis drei Monate ein sinnvoller Richtwert.

Wichtig ist außerdem die Lagerkapazität. Kartons benötigen deutlich mehr Platz als viele Gründer anfangs kalkulieren.

Verpackungsgesetz und LUCID nicht vergessen!

Ein häufiger Fehler vieler E-Commerce-Einsteiger betrifft die gesetzlichen Pflichten rund um Verpackungen.

Sobald Du Verpackungen gewerblich in Umlauf bringst, greift in Deutschland das Verpackungsgesetz. Das betrifft praktisch jeden Online-Shop.

Du musst Dich deshalb bei der Zentralen Stelle Verpackungsregister registrieren und eine sogenannte LUCID-Nummer beantragen. Zusätzlich ist eine Beteiligung an einem dualen System erforderlich.

Wer diese Pflichten ignoriert, riskiert Abmahnungen und Bußgelder. Viele Gründer kümmern sich erst darum, wenn der Shop bereits läuft. Sinnvoller ist es, das Thema direkt vor dem Verkaufsstart sauber aufzusetzen.

Gründer*in der Woche: malmachen - Bootstrapping statt Pitchdeck

Kein VC-Geld, aber echte Kund*innen: Wie ein Start-up aus Deggendorf mit Voice-KI den Mittelstand adressiert – und warum Bootstrapping eine ernstzunehmende Alternative zum polierten Pitchdeck sein kann.

Während viele KI-Start-ups ihre Ideen zunächst in Präsentationen für Investoren entwickeln, sind drei Gründer aus Deggendorf einen anderen Weg gegangen. Marco Jülke, Leonhard Pöppel und Anton Kirchner bauen seit 2022 mit der malmachen GbR eine Telefon-KI ohne externes Funding und direkt im Markt auf. Zu einem Zeitpunkt, als es hierzulande kaum praxistaugliche Lösungen gab, begannen sie, reale Anwendungsfälle umzusetzen. Ihr Ansatz war dabei von Anfang an klar formuliert: Nicht erzählen, sondern bauen. Anstatt früh Kapital einzusammeln, arbeiteten sie unmittelbar an konkreten Kund*innenprojekten und entwickelten daraus über drei Jahre eine skalierbare Technologie.

In einem extrem rechen- und technologieintensiven Umfeld war das fehlende Risikokapital dabei durchaus spürbar. „Gerade am Anfang war Telefon-KI technisch extrem aufwendig, weil es kaum fertige Infrastruktur gab, auf die man einfach hätte aufsetzen können“, räumt Mitgründer Marco Jülke ein. Die Folge war viel eigenes Testen, Verwerfen und Neubauen. Rückblickend sieht Jülke in dieser finanziell herausfordernden Zeit jedoch einen entscheidenden Wettbewerbsvorteil. „Weil wir kein großes Kapital im Rücken hatten, konnten wir nicht einfach monatelang im stillen Kämmerlein entwickeln“, so der Gründer. Das Team war gezwungen, die Entwicklung über laufende Projekte zu finanzieren. „Wir haben nicht gebaut, was theoretisch spannend klingt, sondern das, wofür Unternehmen wirklich bereit waren zu zahlen.“ Dieser Druck habe letztlich für ein sehr praxisnahes Produkt gesorgt.

Vom Projektgeschäft zur Plattform

Die Use-Cases des Start-ups umfassen heute konkrete Anwendungen wie automatisierte Inbound-Systeme im Kund*innenservice, KI-gestützte Lead-Qualifizierung sowie Recruiting-Prozesse, bei denen Bewerber*innen ein telefonisches Erstgespräch mit einer KI führen. Ein besonderer Fokus liegt auf Outbound-Prozessen: KI-Systeme kontaktieren neue Leads innerhalb von Sekunden, führen Gespräche und qualifizieren Termine. Die Kundschaft reicht dabei vom Einzelunternehmen bis hin zum Konzern.

Doch gerade bei der Outbound-Telefonie bewegt man sich in Deutschland juristisch auf dünnem Eis. Die rechtlichen Hürden im Hinblick auf den Datenschutz (DSGVO) und das Gesetz gegen den unlauteren Wettbewerb (UWG) sind enorm hoch – automatisierte Kaltakquise ohne vorherige, ausdrückliche Einwilligung ist in der Regel unzulässig. Angesprochen auf die Gefahr, dass die KI für illegale Spam-Anrufe missbraucht werden könnte, zieht Leonhard Pöppel eine klare Haftungsgrenze. „Wir wollen ausdrücklich keine Technologie bauen, die für Spam oder aggressive Kaltakquise genutzt wird“, stellt er klar. Man setze plattformseitig auf strikte Nutzungsbedingungen. Die rechtliche Verantwortung für Datenherkunft und saubere Opt-ins bleibt jedoch beim Nutzer: „Unsere Kunden müssen selbst sicherstellen, dass sie eine rechtliche Grundlage für die Kontaktaufnahme haben.“ Pöppel sieht das Start-up dennoch in der Pflicht: „Unsere Verantwortung liegt darin, Missbrauch nicht zu fördern und Kunden für eine rechtssichere Nutzung zu sensibilisieren.“

Zuletzt vollzog das Unternehmen einen strategischen Wandel: Heute bündeln die Gründer ihre Technologie in einer Self-Service-Plattform und öffnen das Modell über White-Label-Lösungen für Agenturen. Dieser Wechsel senkt zwar die Einstiegshürde, erfordert nun aber ein hohes Nutzer*innen-Volumen, um profitabel zu wachsen.

„Die größte Hürde war, unser gesamtes Praxiswissen aus individuellen Kundenprojekten so zu vereinfachen, dass Unternehmen es selbst nutzen können“, resümiert Anton Kirchner den Pivot. Während man in der Dienstleistung vieles persönlich erklären könne, müsse das Produkt auf einer Plattform selbsterklärend sein. Um das notwendige Wachstum zu generieren, setzt das Team auf strategische Partnerschaften. „Gerade Agenturen sind für uns spannend, weil sie bereits Kundenbeziehungen haben und unsere Plattform nutzen können, um KI-Telefonie in bestehende Prozesse zu integrieren“, rechnet Kirchner vor.

Die Strategie der Marktmitte

Der Markt für KI-Telefonassistenten ist in den letzten 24 Monaten explodiert. Auf der einen Seite stehen hochfinanzierte Enterprise-Schwergewichte wie das Berliner Start-up Parloa, auf der anderen drängen globale US-Provider wie Vapi oder ElevenLabs in den DACH-Raum. Malmachen positioniert sich dazwischen: prozessnäher als reine US-Schnittstellen, aber zugänglicher als hochpreisige Enterprise-Lösungen.

Doch was hindert einen der globalen Tech-Riesen daran, den deutschen Mittelstand mit einem eigenen Frontend aufzurollen? Leonhard Pöppel verweist hierbei auf die Firmen-DNA: „Unser Ansatz war von Anfang an ein anderer – nicht aus Angst vor Wettbewerb zu handeln, sondern konsequent zu bauen, zu testen und zu verbessern. Genau daraus ist auch unser Name entstanden.“ Das über Jahre gewachsene operative Know-how im Mittelstand betrachten die Gründer als ihren eigentlichen Burggraben. „Ein globaler Player kann Technologie replizieren – aber nicht ohne Weiteres die gewachsene Marktkenntnis, die Nähe zu den Kunden und die daraus resultierende Produktqualität“, zeigt sich Pöppel überzeugt.

Profitabilität statt Pitchdeck

Für die Start-up-Szene liefert das Deggendorfer Unternehmen damit einen markanten Gegenentwurf zum üblichen Funding-first-Narrativ. Das Team beweist, dass es im kapitalintensiven KI-Sektor möglich ist, ohne Millionen-Runde und sofortigen Hyperscaling-Druck einen Product-Market-Fit anhand echter Umsätze zu validieren.

Ob das Team diesem Weg dauerhaft treu bleibt, ist offen. „Bootstrapping war für uns in der Anfangsphase genau der richtige Weg“, bilanziert Anton Kirchner. Beim Thema externes Kapital zeige man sich für das weitere Wachstum jedoch nicht dogmatisch. Sollte VC-Geld helfen, die Plattform professioneller zu skalieren, sei dies eine Option. Eine Bedingung knüpft Kirchner aber daran: „Es geht nicht um Geld allein. Der richtige Kapitalgeber sollte auch strategisch zu uns passen, Know-how mitbringen und Türen öffnen.“ Kapital nur um des Kapitals willen schließt der Gründer kategorisch aus.

DeepTech trifft Food-Safety: 2,6 Mio. Euro für NanoStruct

Food-Safety-Revolution? NanoStruct weist Bakterien in Stunden statt Tagen nach & holt 2,6 Mio. € Seed-Kapital. Wir machen den DeepTech-Check.

Frische Lebensmittel sind ein Wettlauf gegen die Zeit. Bislang dauert der Nachweis von gefährlichen Erregern wie Salmonellen oder Listerien oft mehrere Tage – ein erhebliches Risiko für verderbliche Waren. Das Würzburger Uni-Spin-off NanoStruct will diesen Engpass mit einer neuen Analyseplattform beheben und hat dafür nun eine Seed-Finanzierung in Höhe von 2,6 Millionen Euro eingesammelt. Doch wie tragfähig ist das DeepTech-Modell in der konservativen Lebensmittelindustrie wirklich?

Das Würzburger Startup NanoStruct tritt an, um die mikrobiologische Lebensmittelanalyse von Grund auf zu beschleunigen. Durch die Kombination von optischer Messtechnik, Nanotechnologie, Biotechnologie und maschineller Datenauswertung soll der Nachweis pathogener Bakterien von mehreren Tagen auf wenige Stunden schrumpfen.

Die aktuelle Seed-Runde über 2,6 Millionen Euro bringt namhafte Investoren an Bord: Angeführt wird die Runde vom High-Tech Gründerfonds (HTGF), Bayern Kapital und dem AUXXO Female Catalyst Fund. Ergänzt wird das Kapital durch drei Business Angels aus dem Netzwerk von BayStartUP.

Gold-Antennen statt Petrischalen

Im Kern basiert das Verfahren von NanoStruct auf der sogenannten Surface-enhanced Raman Spectroscopy (SERS). Die Sensoren nutzen dabei ultrapräzise Gold-Nanoantennen, um selbst geringste Mengen von Bakterien verlässlich zu identifizieren.

Interessant ist hierbei ein Blick auf die technologischen Versprechungen: Während das Startup in jüngsten Einreichungen für Branchenpreise (wie den AMA Innovationspreis 2025) noch explizit von einem "Drei-Minuten-Bakterientest" sprach, stapelt die aktuelle Pressemitteilung etwas tiefer und verspricht eine Verkürzung auf "wenige Stunden". Dies ist ein bekanntes Phänomen in der Bio-Sensorik: Während die reine optische Messung im Labor oft nur Minuten dauert, nimmt die komplexe Probenaufbereitung aus realen, unsauberen Lebensmittelmatrizen in der Praxis weiterhin Stunden in Anspruch. Dennoch: Ein Testergebnis noch am selben Tag ("Same-Day-Detection") bedeutet für Produzenten einen gewaltigen Fortschritt.

Aus dem Uni-Labor zum Millionen-Funding

Die Wurzeln des Unternehmens liegen in der Julius-Maximilians-Universität Würzburg, aus der NanoStruct 2021 ausgegründet wurde. Das Gründerteam vereint dabei interdisziplinäre Kompetenzen:

Dr. Henriette Maaß (CEO) verantwortet die Unternehmensstrategie. Sie führte das Startup bereits erfolgreich durch das EU-Förderprogramm "Women TechEU", welches von Frauen geführte Hochtechnologie-Startups unterstützt.

Enno Schatz (CTO) bringt als Experte für Nano-Optik und Sensorik das tiefe technologische Know-how ein.

Kai Leibfried (CFO) steuert die Finanzierung, Geschäftsentwicklung und die kaufmännischen Prozesse.

Der Weg zur Seed-Runde wurde unter anderem durch BayStartUP geebnet: Bereits 2021 gewann das Team das Finale des Businessplan-Wettbewerbs Nordbayern. Aus diesen ersten Berührungspunkten entwickelte sich laut Carsten Rudolph, Geschäftsführer von BayStartUP, das heutige Investorenkonsortium.

Markt, Geschäftsmodell und Wettbewerb – Eine Einordnung

Mit dem frischen Kapital plant NanoStruct nun die Industrialisierung der Technologie, erste Pilotprojekte mit Kunden sowie den Ausbau des Vertriebs. Langfristig sehen die Investoren das Potenzial der Plattform-Technologie auch in weiteren kritischen Bereichen wie der Wasserversorgung, der Medizintechnik oder der Diagnostik.

StartingUp ordnet das Vorhaben wie folgt ein:

Der Markt (Pro): Das wirtschaftliche Potenzial ist enorm. Erreger-Tests am selben Tag reduzieren Lebensmittelverschwendung drastisch, da verderbliche Waren nicht mehr tagelang in Quarantäne-Lagern auf ihre Freigabe warten müssen. Zudem lassen sich millionenschwere, rufschädigende Rückrufaktionen frühzeitig abwenden.

Markteintrittsbarrieren (Contra): Die Lebensmittelindustrie ist hochgradig konservativ und streng reguliert. Ein neues Testverfahren muss nicht nur schneller, sondern zu 100 Prozent fehlerfrei arbeiten. "False-Positives" (falscher Alarm) kosten die Industrie Geld, "False-Negatives" gefährden Menschenleben. Das Vertrauen der Industrie in etablierte Standardverfahren ist historisch gewachsen und tief verankert.

Hardware-Skalierung: Im Gegensatz zu reinen Software-Geschäftsmodellen muss NanoStruct die SERS-Sensoren auf Nanotechnologie-Basis wirtschaftlich in Masse herstellbar machen. Die Skalierung von DeepTech-Hardware verschlingt erfahrungsgemäß viel Zeit und hohe Folgeinvestitionen.

Der Wettbewerb: NanoStruct tritt gegen milliardenschwere Diagnostik-Konzerne und etablierte Verfahren wie PCR-Tests an. Der entscheidende USP von NanoStruct wird es sein, zu beweisen, dass die Sensoren in der rauen industriellen Praxis tatsächlich so robust, günstig und verlässlich sind, dass sie die immensen Wechselkosten für Großkunden rechtfertigen.

Fazit

NanoStruct bringt technologisch exzellente Voraussetzungen mit und hat sich mit dem HTGF, Bayern Kapital und AUXXO sehr starke, gut vernetzte Partner gesichert. Gelingt es dem Team nun, die Technologie aus dem Würzburger Labor erfolgreich in die industrielle Realität der Lebensmittelproduktion zu übertragen, könnte das Startup tatsächlich einen neuen Goldstandard in der mikrobiologischen Qualitätskontrolle etablieren. Die wichtigste Phase – der Beweis am Kunden – beginnt jetzt.

Gründer*in der Woche: SIRPLUS – Überlebenskampf im Food-Outlet-Markt

Während der millionenschwere Rivale Motatos aus Deutschland flieht, schreibt ein einstiger Sanierungsfall plötzlich schwarze Zahlen. Wie unser(e) Gründer*in der Woche – das Berliner Social Business SIRPLUS von Raphael Fellmer – vom gehypten Start-up zum krisenerprobten Mittelständler reifte.

Das Berliner Social Business SIRPLUS hat bewegte Jahre hinter sich. Nach einer überstandenen Insolvenz 2024 erfindet sich das ehemalige Vorzeige-Start-up um Gründer Raphael Fellmer aktuell neu – und setzt auf Community statt auf klassisches VC-Kapital. Mitten in diese Konsolidierungsphase platzt im April 2026 der Deutschland-Rückzug des Konkurrenten Motatos. Ein Lehrstück über die harten Grenzen des Skalierens und den schmerzhaften Weg vom gehypten Start-up zum krisenerprobten Mittelständler.

Paradoxon im Food-Markt: Der Sanierungsfall überlebt den Giganten

Es ist eine Nachricht, die in der hiesigen FoodTech-Szene aktuell für ein mittelschweres Beben sorgt: Der schwedische Online-Discounter Motatos zieht sich aus Deutschland zurück. Trotz rund 300.000 aktiven Kund*innen und einem beachtlichen Jahresumsatz von über 35 Millionen Euro zieht das Unternehmen Mitte April 2026 die Reißleine. Das Deutschland-Geschäft blieb hochgradig defizitär. Die Begründung: Man wolle sich auf das profitable Wachstum in den nordischen Heimatmärkten konzentrieren. Dieser Rückzug wirft ein grelles Licht auf die strukturellen Herausforderungen des deutschen Lebensmittelmarkts. Doch während der finanzstarke Konkurrent aus dem Norden kapituliert, hält ausgerechnet das Berliner Unternehmen SIRPLUS die Stellung – ein Turnaround-Case, der erst vor Kurzem selbst am Abgrund stand.

Warum überlebt SIRPLUS dort, wo ein millionenschwerer Riese aufgibt? Gründer Raphael Fellmer macht sich keine Illusionen über das Marktumfeld. „Wir haben in Deutschland wohl einen der härtesten umkämpften Lebensmittelmärkte in der EU“, analysiert er die Lage. Dass nach dem US-Giganten Walmart nun mit Motatos der nächste Konzern den Rückzug antrete, sei bezeichnend. Die eigene Überlebensstrategie liege in den Lehren der bitteren Vergangenheit. „Wir haben bei SIRPLUS 2.0 einen so radikalen Pivot hingelegt, wie ich es nicht für möglich gehalten hätte“, betont der Gründer. Das Erfolgsrezept liege heute nicht mehr in der reinen Größe, sondern in extremer Agilität und einem strikten Fokus auf organisches Wachstum. Die Rechnung scheint aufzugehen: Auch wenn die Berliner rund 20-mal weniger Umsatz machen als der scheidende Konkurrent Motatos, schreiben sie laut Fellmer bereits schwarze Zahlen. Für 2026 kündigt er erstmals seit der Gründung mehr Einnahmen als Ausgaben an.

„Das entlastet mich persönlich sehr, weil ich seit Jahren im Dauerfunding-Modus bin.“

Raphael Fellmer über die ersten schwarzen Zahlen seit der Gründung 2017

„Wir sind nicht per Du“: Wenn Purpose auf Realität prallt

Die Geschichte von SIRPLUS ist untrennbar mit seinem prominenten Gründer verbunden. Der Klimaaktivist erlangte Bekanntheit, weil er aus Protest gegen die Wegwerfgesellschaft fünfeinhalb Jahre lang komplett ohne Geld lebte und sich durch „Containern“ ernährte. Nach dem Aufbau der Foodsharing-Initiative folgte 2017 gemeinsam mit Martin Schott die Gründung von SIRPLUS. Das Kern-Geschäftsmodell: Das Unternehmen rettet bei Produzent*innen und Großhändler*innen überschüssige Ware – etwa wegen nahendem Mindesthaltbarkeitsdatum (MHD), Überproduktionen oder Verpackungsfehlern – und verkauft diese D2C (Direct-to-Consumer) über den eigenen Online-Shop mit Rabatt an Endkund*innen.

Damals griff das Team mit diesem Konzept nach den Sternen des klassischen Start-up-Wachstums. Doch der Spagat zwischen Weltverbesserung und knallhart skalierbarem E-Commerce erwies sich als tückisch. Das zeigte sich eindrücklich im September 2019 bei einem denkwürdigen Auftritt in der TV-Show Die Höhle der Löwen. Fellmer und Schott forderten 700.000 Euro für 6 Prozent der Anteile – was einer überaus ambitionierten Firmenbewertung von fast 11,7 Millionen Euro entsprach.

Die Kombination aus Social-Impact-Rhetorik und massiver kapitalistischer Bewertung sorgte für einen beispiellosen Eklat. Investor Georg Kofler warf dem Duo „moralisierendes Schöngerede“ vor. Als die Gründer sich rechtfertigen wollten und Kofler dabei duzten, unterbrach dieser scharf mit einem Satz, der in die deutsche TV-Geschichte einging: „Wir sind nicht per Du. Unter Multimillionären ist man eine Weile per Sie.“ Das Team verließ das Studio ohne Deal. Die Investoren hatten den wunden Punkt getroffen: Ein gesellschaftliches Problem moralisch aufzuladen, heilt keine schwachen Unit Economics.

Rückblickend gibt sich Fellmer geläutert, verhehlt aber auch seine damalige Verletztheit nicht. Die Einladung zur Show habe man primär angenommen, um Reichweite für das Thema Lebensmittelverschwendung zu generieren. „Dass wir so stark kritisiert und vor allem auch persönlich angegriffen würden, hätte ich mir nicht vorstellen können“, gibt er unumwunden zu. Die völlig überzogene Firmenbewertung rechnet er heute der eigenen Naivität an: „Wir kannten uns nicht aus und waren glücklich darüber – ohne zu verstehen, dass eine zu hohe Bewertung auch hinderlich sein kann.“

Der harte Cut: Vom 90-Köpfe-Team zum Sanierungsfall

Die Kritik der Löwen sollte sich in gewisser Weise als prophetisch erweisen. Das Geschäftsmodell erfordert es, schwere, niedrigpreisige Güter aufwendig zu lagern, zu kommissionieren und per Paketdienst zu verschicken. Die Logistikkosten fraßen die Margen auf. Als Ende 2023 im ohnehin schwierigen Marktumfeld eine rettende Finanzierungsrunde platzte, musste SIRPLUS im Januar 2024 Insolvenz anmelden. Und das, obwohl das Team von ehemals rund 90 auf unter 30 Mitarbeitende Monate vor der Pleite radikal eingedampft wurde. Die verlustreichen stationären „Rettermärkte“ gehörten schon zwei Jahre zuvor der Vergangenheit an. Im Mai 2024 gelang zwar die Rettung durch drei Viertel der Bestandsinvestor*innen, doch der Preis war hoch: Aus dem einstigen Hyper-Wachstums-Narrativ wurde ein harter Überlebenskampf. SIRPLUS wurde zeitweise vom gehypten Start-up zum Sanierungsfall.

„Es war sehr hart, nach sieben Jahren Kampf anzuerkennen, dass wir es einfach nicht geschafft haben, wirtschaftlich zu werden.“

Raphael Fellmer über den Tiefpunkt vor dem Neustart

Der personelle Aderlass ging an die Substanz. Zwischenzeitlich kämpfte der Gründer praktisch allein, mit seinem Bruder als einzigem Mitarbeiter. Dennoch sei sein Wille ungebrochen gewesen. Den operativen Neustart nach der Pleite diktierte der Rotstift: „Leane Struktur ohne Obst und Gemüse, keine bezahlte Werbung, sondern organisches Wachstum, kein Büro, sondern Remote-Only“, summiert Fellmer die harten Schnitte. Statt teurer Bezahldeals stütze man sich heute auf langfristige Partnerschaften.

Der radikale Pivot: Community statt teurer Klicks

Aktuell ist SIRPLUS Teil der neuen YouTube-Show The Green Deal, ein Format, das gezielt die Abkehr vom rein kapitalgetriebenen Skalieren propagiert. Der neue Hebel für SIRPLUS: Reichweite, Community-Building und Creator-Beteiligungen. Die betriebswirtschaftliche Logik dahinter ist zwingend: Wenn hohe Customer Acquisition Costs (CAC) im klassischen Performance-Marketing das ohnehin margenschwache Modell ruinieren, muss die Kundenakquise organisch erfolgen. Durch die enge Bindung an Influencer und eine wertegetriebene Community sollen treue Käufer*innenschichten aufgebaut werden.

Dass dieses Konzept mehr als nur eine Notlösung für fehlendes VC-Geld ist, belegen harte Zahlen. Fellmer beziffert die aktuellen Customer Acquisition Costs stolz auf „unter 5 Euro“. Dieser Wert sei sieben- bis zehnmal besser als noch zu Zeiten von SIRPLUS 1.0. Auf klassische Bezahlkooperationen verzichtet das Start-up mittlerweile völlig; man vergütet rein über Umsatzbeteiligungen oder gespendete Schulmahlzeiten. „Wir suchen weiter nach authentischen Partnerschaften mit Menschen mit Reichweite, die sich für eine Welt einsetzen wollen, in der alle genügend zu essen haben“, skizziert Fellmer sein Anforderungsprofil an Creator. Die Strategie trägt Früchte: Von Q1 2025 auf Q1 2026 verzeichnete das Unternehmen laut Gründer ein Wachstum von 100 Prozent.

Die SIRPLUS-Formel: Drei harte Lektionen für Social Start-ups

Warum widmen wir uns bei StartingUp einem neunjährigen Unternehmen, das streng genommen längst kein Start-up mehr ist? Weil junge Gründer*innen aus exakt dieser Transformation unbezahlbare Lehren für die eigene Frühphase ziehen können:

- Purpose ersetzt keine Unit Economics: Der Fall SIRPLUS demonstriert schonungslos, dass selbst die stärkste gesellschaftliche Mission eine fehlerhafte betriebswirtschaftliche Basis (hohe Logistikkosten bei niedrigen Warenkörben) nicht dauerhaft kompensieren kann. Wer heute ein Social Start-up gründet, muss seine Margen noch rigoroser verteidigen als traditionelle E-Commerce-Modelle.

- Die Grenzen des VC-Modells erkennen: Nicht jedes Geschäftsmodell eignet sich für Venture Capital. Die Entwicklung von SIRPLUS und der aktuelle Motatos-Exit zeigen, dass der Food-Outlet-Markt extrem schwer zu skalieren ist. Junge Start-ups lernen hier, alternative Wachstumswege frühzeitig in Betracht zu ziehen, bevor sie sich in eine gefährliche VC-Abhängigkeit begeben.

- Resilienz als Kernkompetenz: Dass Raphael Fellmer das Tal der Tränen durchschritten hat und sich dem Markt nach einer Insolvenz mit angepasstem Modell neu stellt, ist ein Meisterkurs in Pivotierung und unternehmerischer Widerstandskraft.

Die Konkurrenzsituation hat sich durch den Motatos-Exit nun paradoxerweise entspannt. Ob die Gleichung „Reichweite statt Performance-Marketing“ am Ende aufgeht, wird eine der spannendsten Case Studies der aktuellen Wirtschaftsszene – und ein wertvoller Blueprint für die Start-ups von morgen.

Fellmer selbst zeigt sich für die Zukunft demütig, aber siegessicher. Auf dem Weg zur Profitabilität habe man zwar fast 10 Millionen Euro an Funding benötigt und schmerzhaftes Lehrgeld gezahlt, doch „das Dranbleiben, Neudenken und nicht Aufgeben hat sich gelohnt“. Für 2026 verspricht der Gründer erstmals ein nachhaltig profitables Gesamtjahr. Neben der rein wirtschaftlichen Stabilität hat der passionierte Kämpfer gegen Food Waste inzwischen aber auch einen „ganz profanen“ Meilenstein im Visier: „Für mich persönlich ist dieses Jahr ein echter mehrwöchiger Urlaub nach 14 Jahren des Fast-Durch-Arbeitens ein wichtiges Ziel.“

Wie das TechBio-Start-up mbiomics mit 30 Mio. Euro die Krebstherapie skalierbar machen will

Stuhltransplantationen haben gezeigt, dass das Darmmikrobiom ein mächtiger Hebel gegen Krebs sein kann – doch der Ansatz ist bisher kaum standardisierbar. Das Münchner Unternehmen mbiomics setzt auf künstliche Intelligenz und maßgeschneiderte Bakterien-Cocktails aus dem Labor. Mit dem Abschluss einer 30-Millionen-Euro-Serie-A-Runde rückt die klinische Phase näher. Ein genauer Blick auf das Geschäftsmodell, die Gründer*innen und einen hart umkämpften globalen Markt.

Wer heute von modernster Krebstherapie spricht, kommt am menschlichen Darm nicht mehr vorbei. Die wissenschaftliche Datenlage der letzten Jahre hat sich massiv verdichtet: Ob ein Patient auf revolutionäre Krebs-Immuntherapien (wie Immun-Checkpoint-Inhibitoren) anspricht, hängt maßgeblich von der individuellen Zusammensetzung seines Mikrobioms ab. Das Münchner TechBio-Unternehmen mbiomics hat sich genau dieses Zusammenspiel zur Mission gemacht und gab heute den dritten Abschluss seiner Serie-A-Finanzierungsrunde bekannt. Mit neu eingeworbenen 12 Millionen Euro wächst das Gesamtvolumen der Runde auf beachtliche 30 Millionen Euro.

Das Kapital, das unter anderem von erfahrenen Investoren wie den MIG Fonds und Bayern Kapital stammt, markiert für das 2020 gegründete Unternehmen einen entscheidenden Wendepunkt: den Übergang von der reinen Technologieplattform hin zur klinischen Anwendung am Menschen. Der führende Wirkstoffkandidat „MBX-116“ soll 2027 in einer Phase-1B-Studie an Patienten mit fortgeschrittenem schwarzen Hautkrebs (Melanom) getestet werden. Doch wie belastbar ist dieser Ansatz im Vergleich zum Wettbewerb?

Die Köpfe hinter der Vision

Aus der Taufe gehoben wurde mbiomics im Jahr 2020 von Dr. Laura Figulla, Dr. Johannes B. Wöhrstein und Dr. Markus Rinecker. Während die Mitgründer Figulla und Rinecker das Unternehmen in der frühen Phase prägten, wird die nun anstehende Skalierung und klinische Validierung von einem spezialisierten Leadership-Trio gesteuert:

- Dr. Johannes B. Wöhrstein (CEO & Mitgründer): Als technologischer Kopf und Geschäftsführer verantwortet er die firmeneigene Plattform. Seine Expertise in hochauflösender Analytik ist das Fundament, um komplexe mikrobielle Netzwerke mithilfe von maschinellem Lernen (KI/ML) überhaupt erst zu kartieren.

-

Kristin Torre Vinuesa (CFO): Als Chief Financial Officer verantwortet sie die finanziellen Geschicke des Unternehmens. Ihre Rolle ist entscheidend, um die neu eingeworbenen 30 Millionen Euro strategisch einzusetzen, den naturgemäß hohen Kapitalbedarf der anstehenden klinischen Studien („Cash Burn“) effizient zu steuern und das finanzielle Fundament für zukünftige Runden zu sichern.

- Dr. Christopher Weidenmaier (CSO): Der erfahrene Mikrobiologe (zuvor unter anderem beim US-Konkurrenten Finch Therapeutics) komplettiert das heutige Führungstrio. Als Chief Scientific Officer leitet er die präklinische Forschung und treibt das rationale Design der komplexen Bakterien-Konsortien maßgeblich voran.

Das Problem: Die Unberechenbarkeit der Natur

Um das Geschäftsmodell zu verstehen, muss man den Status quo betrachten. In der Onkologie wird aktuell intensiv mit Stuhltransplantationen (Fecal Microbiota Transplants, FMT) experimentiert. Dabei wird das Mikrobiom von Patient*innen, die hervorragend auf Krebsmedikamente ansprechen, auf „Non-Responder“ übertragen. Die Erfolge sind bemerkenswert, doch das Verfahren hat einen massiven Haken: Stuhl ist ein hochvariables Naturprodukt. Er ist schwer zu standardisieren, birgt Infektionsrisiken und lässt sich nicht als skalierbares Pharma-Produkt im industriellen Maßstab herstellen.

Hier setzt mbiomics mit sogenannten Live Biotherapeutic Products (LBPs) an. Statt auf ungefilterte Spender*innen-Transplantate zu setzen, identifiziert das Team mittels KI genau jene Bakterienstämme, die für den therapeutischen Effekt verantwortlich sind. Diese werden dann im Labor nach pharmazeutischen GMP-Standards gezüchtet und als orale Kapsel verabreicht. Es ist der Versuch, die „Blackbox“ Darm in ein berechenbares, patentierbares Medikament zu verwandeln.

Wo liegen die Risiken?

Für Beobachter*innen der Start-up-Szene bleibt das Vorhaben trotz der Millionen-Finanzierung eine Hochrisiko-Wette. Ein TechBio-Start-up in diesem Stadium hat einen enormen „Cash Burn“. Die 30 Millionen Euro sind ein starkes Fundament, doch die klinische Entwicklung in der Onkologie ist ein Langstreckenlauf, der oft dreistellige Millionenbeträge verschlingt.

Zudem ist das Geschäftsmodell hochgradig binär: Die für 2027 geplante Studie muss erst beweisen, dass die im Labor designten Bakterien-Konsortien im komplexen menschlichen Ökosystem tatsächlich die erhoffte Wirkung zeigen. Ein Scheitern des Leitkandidaten MBX-116 könnte das gesamte Vertrauen in die Plattform erschüttern. Zudem ist die Herstellung lebender Bakterien in absolut reproduzierbarer Qualität eine enorme logistische und biotechnologische Herausforderung, an der bereits andere Pioniere der Branche hängen geblieben sind.

Der Markt: Ein globales Rennen

Mbiomics ist nicht allein auf diesem Feld. Das Unternehmen muss sich gegen hochkapitalisierte internationale Konkurrent*innen behaupten:

- MaaT Pharma (Frankreich): Die Franzosen sind klinisch bereits weiter fortgeschritten und setzen auf „Full-Ecosystem“-Produkte aus gepoolten Spenderproben. Mbiomics muss beweisen, dass ihr synthetischer Präzisions-Ansatz dem natürlichen Mix überlegen ist.

- Vedanta Biosciences (USA): Ein US-Schwergewicht, das ebenfalls definierte Bakterienkonsortien entwickelt und bereits über ein breites Netzwerk an Kooperationen mit der Big-Pharma-Industrie verfügt.

Unsere Einordnung

Für das deutsche Ökosystem ist der Erfolg von mbiomics ein Leuchtturm-Signal. Dass Investoren wie MIG – die bereits bei BioNTech ein frühes Gespür bewiesen – hier massiv nachlegen, unterstreicht die Qualität des Standorts München.

Mbiomics wählt den schwierigen, aber potenziell nachhaltigeren Weg. Statt auf die bloße Kopie der Natur zu setzen, versucht das Team, das Mikrobiom durch Daten beherrschbar zu machen. Gelingt der klinische Wirksamkeitsnachweis ab 2027, könnte das Start-up nicht nur die Onkologie verändern, sondern auch Blaupausen für die Behandlung von Autoimmun- und neurodegenerativen Erkrankungen liefern. Der Weg bis dahin bleibt jedoch teuer und wissenschaftlich riskant.

Wenn das Team zum Flaschenhals wird: Warum Start-ups oft an „Ghost Positions“ scheitern

Schnelles Wachstum birgt Risiken: Wachsen Teams nicht mit, entstehen toxische „Ghost Positions“. Ex-Tibber-Deutschland-Chefin Marion Nöldgen erläutert im Interview, wie Gründer*innen gegensteuern.

Schnelles Wachstum – die sogenannte Hypergrowth-Phase – ist das ultimative Ziel und oft die wichtigste Metrik nach einer erfolgreichen Finanzierungsrunde. Doch genau im Moment des größten Triumphs lauert eine der gefährlichsten Fallen für junge Unternehmen: Das Start-up skaliert rasant, aber die Menschen und die internen Strukturen kommen nicht mehr hinterher.

Die Folgen dieses mangelhaften „People Scalings“ werden oft viel zu spät erkannt und können das Wachstum empfindlich bremsen. Ein typisches Symptom sind sogenannte Heritage Hires: Mitarbeitende der ersten Stunde, die aus Loyalität und Historie plötzlich in große C-Level- oder VP-Rollen hineingewachsen sind, denen sie fachlich oder führungstechnisch (noch) nicht gewachsen sind. Ignoriert die Geschäftsführung dieses Problem, reagiert das System von selbst – es entstehen „Ghost Positions“. Im Schatten des offiziellen Organigramms bilden sich heimliche Parallelstrukturen, um eigentlich zuständige, aber überlastete oder überforderte Führungskräfte schlichtweg zu umgehen.

Wie Gründer*innen diese tückischen Wachstumsfallen rechtzeitig erkennen und proaktiv auflösen, weiß die Clearimpact-Gründerin Marion Nöldgen. Als Expertin für Organizational Design und zertifizierte Aufsichtsrätin kennt sie die Wachstumsschmerzen schnell skalierender Unternehmen aus erster Hand. In den vergangenen zehn Jahren hat sie als Geschäftsführerin mehrere Start-ups aufgebaut, internationalisiert und durch extreme Wachstumsphasen geführt – unter anderem die deutsche Tochter des GreenTech-Unternehmens Tibber, den bekannten Pionier für dynamische Stromtarife.

Im StartingUp-Interview erklärt sie, warum die meisten Businesspläne nicht am Markt, sondern am falschen Team-Setup scheitern, wie man schwierige Gespräche mit loyalen Mitarbeitenden der ersten Stunde führt und wie ein Organisationsdesign aussehen muss, das echtes Wachstum aushält.

Marion, du hast in den letzten zehn Jahren zahlreiche Unternehmen gegründet, internationalisiert und in absolute Hypergrowth-Phasen begleitet. Wenn du auf diese Zeit zurückblickst: Was war dein größtes Learning in Bezug auf das Team-Wachstum?

Marion Nöldgen: Dass Wachstum nicht daran scheitert, dass man zu wenig gute Leute hat – sondern daran, dass man sie nicht richtig einsetzt.

In frühen Phasen funktioniert viel über Intuition, Vertrauen und Geschwindigkeit. Das trägt einen ziemlich weit. Aber irgendwann kippt das System. Rollen werden größer, Anforderungen komplexer – und plötzlich reicht es nicht mehr, dass jemand „gut ist“. Er oder sie muss auch schnell genug mit einer Rolle mitgewachsen sein.

Gleichzeitig verändert sich die Struktur selbst. Was am Anfang gebraucht wurde, gibt es in dieser Form später oft gar nicht mehr – oder es kommen komplett neue Anforderungen dazu, für die es vorher schlicht keine Rolle gab.

Mein größtes Learning: Man muss nicht nur die richtigen Leute holen und halten, sondern auch Rollen aktiv weiterentwickeln – und beides immer wieder neu aufeinander abstimmen. Sonst wächst das Unternehmen, aber die Organisation hält nicht mit.

In deiner aktuellen These triffst du einen wunden Punkt: Du sagst, die meisten Businesspläne scheitern nicht am Markt, sondern am falschen Team. Warum wird das People Scaling – im Gegensatz zum Skalieren von Produkt oder Vertrieb – von Gründer*innen oft so stiefmütterlich behandelt?

Marion Nöldgen: Weil es deutlich unangenehmer ist.

Produkt, Vertrieb, Zahlen – das ist rational. Da kann ich Hypothesen testen, optimieren, Entscheidungen treffen. Beim Team geht es um Menschen, Beziehungen, Loyalität und offene Konflikte. Da wird es erstens schnell persönlich und zweitens dauert es oft lange, bis die Probleme überhaupt sichtbar werden. Schlechte Produktentscheidungen merkt man relativ schnell. Schlechte Teamentscheidungen oft erst Monate später – wenn Strukturen schon verhärtet sind.

Viele hoffen dann, dass es sich „einfach einspielt“. Tut es aber meistens nicht.

Lass uns über ein sehr sensibles Thema sprechen: Heritage Hires. Oft wachsen Mitarbeiter der ersten Stunde plötzlich in Führungspositionen (z.B. als VP oder Head of) hinein, für die sie eigentlich (noch) nicht bereit sind. Ab wann wird Loyalität hier zum Wachstumsrisiko für das Unternehmen?

Marion Nöldgen: In dem Moment, in dem die Rolle mehr verlangt, als die Person leisten kann – und man es trotzdem laufen lässt. Loyalität ist extrem wertvoll. Gerade in der Anfangsphase. Aber sie ist kein Ersatz für Erfahrung oder Führungsfähigkeit.

Das Risiko entsteht nicht dadurch, dass jemand noch nicht so weit ist – das ist normal. Es entsteht, wenn man weder Rolle noch Besetzung anpasst, obwohl beides längst nicht mehr zusammenpasst.

Die menschliche Komponente ist hier extrem schwierig: Wie gehe ich als Gründer*in oder CEO das Gespräch mit einem hochverdienten Heritage Hire an, wenn ich merke, dass die Rolle zu groß geworden ist, ohne diese Person zu demotivieren oder gar ans Unternehmen zu verlieren?

Marion Nöldgen: Indem man Rolle und Besetzung klar trennt – und genau so ins Gespräch einsteigt. Also nicht über die Person sprechen, sondern über die Rolle: Was muss sie aktuell liefern? Und wo stehen wir heute? Oft ist die Lücke ziemlich offensichtlich – und auch, dass sie nicht realistisch zu schließen ist. Gleichzeitig sollte klar gemacht werden: Es geht nicht darum, die Person zu verlieren. Im Gegenteil – man möchte sie halten und gemeinsam schauen, in welcher Rolle sie künftig wirklich wirksam sein kann.

Die meisten spüren das selbst längst. Was fehlt, ist die klare, ehrliche Ansprache.

Wenn das sauber gemacht wird, stehen die Chancen gut, dass die Person bleibt – nur eben in einer für sie und das Unternehmen wirksamen Rolle.

Ignoriert man das Problem der überlasteten Führungskräfte, entstehen laut dir sogenannte Ghost Positions und Parallelstrukturen. Woran erkenne ich als Geschäftsführung rechtzeitig, dass mein Team anfängt, das eigentliche Organigramm heimlich zu umgehen? Gibt es typische Red Flags?

Marion Nöldgen: Ja, ziemlich klare sogar.

Entscheidungen dauern ungewöhnlich lange – oder werden plötzlich woanders getroffen. Themen „wandern“ durch die Organisation, bis sie jemand entscheidet.

Du siehst, dass Leute sich bewusst andere Ansprechpartner suchen als die eigentlich zuständige Führungskraft. Oder dass Dinge einfach selbst gelöst werden, um voranzukommen.

Das sind alles Signale dafür, dass die formale Struktur nicht mehr mit der Realität übereinstimmt.

Wenn das Kind bereits in den Brunnen gefallen ist und sich Ghost Positions etabliert haben – wie löst man diese Schattenstrukturen wieder auf, ohne dass das operative Geschäft zusammenbricht?

Marion Nöldgen: Auf jeden Fall nicht alle auf einmal!

Der erste Schritt ist Transparenz: sichtbar machen, wie Entscheidungen aktuell tatsächlich getroffen werden. Das ist oft schon ein Augenöffner.

Dann geht es darum, Verantwortung wieder sauber zuzuordnen – und konsequent dorthin zurückzugeben. Das braucht Zeit und Kommunikation.

Und ehrlich gesagt: In manchen Fällen kommt man nicht darum herum, auch personell etwas zu verändern. Alles andere ist Kosmetik.

Als Expertin für Organizational Design: Wie muss eine Unternehmensstruktur aufgebaut sein, die einerseits flexibel genug für die typische Start-up-Agilität ist, andererseits aber stark genug, um Phasen extremen Wachstums (z.B. nach einer Series A oder B) auszuhalten?

Marion Nöldgen: Sie muss klarer sein, als viele denken – aber nicht komplizierter.

Was es braucht, sind klare Rollen, klare Entscheidungswege und ein gemeinsames Verständnis davon, wer für was verantwortlich ist.

Flexibilität entsteht nicht durch Unklarheit, sondern dadurch, dass alle wissen, wo sie sich bewegen können. Wenn das fehlt, wird jede Veränderung anstrengend.

Wie bindet man Weiterbildung und Leadership-Training in ein Umfeld ein, in dem eigentlich immer die Devise „Execution first“ gilt?

Marion Nöldgen: Indem man es auch genau so behandelt: als Teil der Arbeit – nicht als Extra. Ich bin kein großer Fan von Wochenend-Workshops oder theoretischen Trainings „on top“. Gerade in frühen Wachstumsphasen bringt das wenig.

Entscheidend ist Training on the job. Das heißt konkret: Lernen passiert im Alltag. In echten Meetings, echten Entscheidungen, echten Situationen. Genau dort kann man direkt Feedback geben – zum Beispiel, wenn ein Teammeeting unklar geführt ist oder Erwartungen nicht sauber formuliert werden.

Es geht weniger um Theorie und mehr darum, in der konkreten Arbeit besser zu werden.

Zum Abschluss: Wenn du einem Gründungsteam, das gerade ein großes Funding abgeschlossen hat und kurz davor steht, sein Team zu verdreifachen, nur einen einzigen Rat mit auf den Weg geben dürftest – welcher wäre das?

Marion Nöldgen: Schaut euch ehrlich in die Augen und fragt euch: Was müssen wir konkret liefern, um das, was wir gepitcht haben, wirklich umzusetzen? Also: Welchen Output muss jede einzelne Rolle erzeugen – nicht high level, sondern ganz konkret, was ist das Ergebnis dieser Arbeit?

Wer verantwortet welchen Teil – und kann die Person das auch leisten?

Und wenn nicht, muss man es ansprechen. Früh. Und mittelfristig wahrscheinlich etwas verändern.

Danke, Marion, für die spannenden Insights!

Das Interview führte StartingUp-Chefredakteur Hans Luthardt

110-Mio.-Dollar-Turbo: Sereact verpasst Robotern eine Vorstellungskraft

Mit 110 Mio. Dollar frischem Kapital und „Cortex 2“ greift das Stuttgarter Start-up Sereact die USA an. Die Vision: Roboter, die physikalisch mitdenken, statt nur blind zuzugreifen.

Das 2021 gegründete Stuttgarter Start-up Sereact hat in einer aktuellen Serie-B-Finanzierungsrunde 110 Millionen US-Dollar eingesammelt. Mit dem Versprechen, Industrierobotern durch sogenannte „Weltmodelle“ eine Art situative Vorstellungskraft zu verleihen, zieht das Unternehmen erneut internationale Schwergewichte an. Doch während die Kriegskasse für die anstehende US-Expansion prall gefüllt ist, stellt sich die Frage: Kann der datengetriebene Ansatz aus dem Schwabenland die hochfinanzierte US-Konkurrenz auf ihrem Heimatmarkt wirklich ausstechen? Eine Analyse.

Millionen-Spritze für den Weltmarkt

Die Gründungsgeschichte von Sereact liest sich wie ein europäischer Tech-Traum. Ralf Gulde (CEO) und Marc Tuscher (CTO) starteten 2021 als Ausgründung der Universität Stuttgart. Was mit improvisierten Servern aus gebrauchten Grafikkarten begann, hat sich zu einem globalen Geschäft entwickelt: Nach einer Serie-A-Runde im Jahr 2025 führt nun der VC Headline die 110-Millionen-Dollar-Runde an. Beteiligt sind zudem Bullhound Capital, Daphni und Felix Capital, womit das Gesamtkapital auf über 140 Millionen US-Dollar steigt.

Der Grund für das massive Interesse liegt in der Skalierbarkeit: Mit über 200 europaweit eingesetzten Systemen gilt Sereact als einer der am häufigsten eingesetzten Anbieter von KI-Kommissionierrobotern. Die Kundenliste umfasst Größen wie BMW, Mercedes-Benz, DHL, PepsiCo und die Österreichische Post.

Cortex 2: Denken vor dem Greifen

Bisher basierte der Erfolg auf der Koppelung von Sprachmodellen und Bilderkennung. Mit der neuen Generation „Cortex 2“ geht Sereact einen Schritt weiter: Das System erweitert ein Vision-Language-Action-Modell (VLA) um ein „Weltmodell“. Anstatt nur zu reagieren, gleicht die KI Aktionen mit einem erlernten Modell der Physik ab und wählt den vielversprechendsten Weg aus.

Dieser Wechsel vom Reagieren zum Schlussfolgern ermöglicht komplexe Aufgaben, bei denen feinfühliger Kontakt entscheidend ist – etwa das Zusammenbauen von Komponenten unter Spannung oder das kratzerfreie Anbringen eines Scheibenwischers. CTO Marc Tuscher betont: „Wir bauen keine Roboter. [...] Die Hardware wird zur Massenware. Das Modell nicht.“

Der Eine-Milliarde-Picks-Vorsprung

Sereact positioniert sich als reines Software-Unternehmen, sieht seinen entscheidenden Vorteil jedoch in der Datenqualität. Ein kritischer Blick auf den Markt zeigt:

- Reale Daten vs. Simulation: Während viele Wettbewerber mit simulierten Daten trainieren, wurde Cortex 2 auf Basis von mehr als einer Milliarde realer Greifvorgänge aus der Produktion entwickelt.

- Nachgewiesene Präzision: Sereact begegnet der Skepsis gegenüber KI in der Logistik mit harten Zahlen. Laut Unternehmen erfordert nur noch jeder 53.000. Kommissioniervorgang ein menschliches Eingreifen.

- Hardware-Abhängigkeit: Trotz der Software-Stärke bleibt Sereact darauf angewiesen, dass Kunden in moderne Roboterarme und Sensorsysteme wie die hauseigene „Sereact Lens“ investieren.

Showdown in den USA

Mit der Präsentation auf der MODEX in Atlanta und der geplanten Eröffnung eines Büros in Boston in diesem Sommer bläst Sereact zum Angriff auf den US-Markt. Amerikanische Hersteller fordern produktreife KI, die sofort einsatzbereit ist.

Für die Gründer*innenszene sendet Sereact ein klares Signal: Der nächste Paradigmenwechsel der KI findet in der physischen Welt statt (Embodied AI). Der Erfolg in den USA wird davon abhängen, ob das Stuttgarter Daten-Flywheel auch gegen die gigantischen Budgets der US-Konkurrenz bestehen kann. Sereact hat den Grundstein gelegt, um das „Gehirn“ der globalen Automatisierung zu werden.

Cyber-Souveränität als Geschäftsmodell: QuoIntelligence sichert sich 7,3 Mio. Euro für den europäischen Markt

Regulierung als Wachstumstreiber: Das Frankfurter Cyber-Security-Start-up QuoIntelligence sammelt in seiner Series-A-Finanzierungsrunde 7,3 Millionen Euro ein. Das Versprechen: Hochwertige, fertig analysierte Cyber-Bedrohungsdaten speziell für den europäischen Mittelstand. Doch wie skalierbar ist der Spagat zwischen KI-Automatisierung und menschlicher Analyse, wenn man gegen etablierte US-Giganten antritt?

Der Weg von QuoIntelligence ist eng mit der Biografie seines Gründers Marco Riccardi verknüpft. Riccardi verbrachte sieben Jahre tief im IT-Sicherheitsapparat des Frankfurter Finanzsektors: Von 2013 bis 2015 war er als IT-Security-Berater für die Europäische Zentralbank (EZB) tätig, gefolgt von zwei Jahren als Threat Intelligence Analyst bei der Deutschen Bank. Vor der Gründung von QuoIntelligence Anfang 2020 leitete er zudem die Intelligence Operations beim Frankfurter Unternehmen QuoScient.

Heute führt Riccardi das Start-up mit einem europäisch aufgestellten Management-Team, dem unter anderem David Brown (UK), Antonio Arias Lopez (Deutschland), Odín Rodríguez Lago (Spanien) und Marina Gómez Lara (Spanien) angehören.

„Finished Intelligence“ statt roher Daten-Feeds

QuoIntelligence positioniert sich als Anbieter für „Unified Risk Intelligence“. Das Kernproblem vieler Unternehmen: Der Aufbau eines eigenen Cyber-Intelligence-Teams erfordert oft sechsstellige Investitionen allein für Fachpersonal. QuoIntelligence verspricht hier Abhilfe durch „Finished Threat Intelligence“ – fertig analysierte und kontextualisierte Bedrohungsinformationen, die innerhalb weniger Stunden einsatzbereit sind, ohne dass der Kunde ein eigenes internes Expertenteam benötigt.

Technologisch stützt sich das Unternehmen dabei auf zwei Säulen:

- Mercury: Die hauseigene Plattform aggregiert Erkenntnisse aus über 1.000 Quellen und nutzt eine kuratierte Wissensbasis von über 17.000 geprüften Intelligence-Tickets.

- KARLA: Ein konversationeller KI-Analyst soll diese komplexen Informationen für alle Unternehmensebenen – vom Vorstand bis zum Sicherheitsanalysten – zugänglich machen.

Das Modell stößt auf eine beachtliche Marktresonanz: Für das Jahr 2025 meldet das Startup keinen einzigen Kundenabgang (Zero Client Churn). Zudem hat sich der Customer Lifetime Value seit 2023 beinahe versechsfacht. Ein weiterer Vertrauensbeweis ist die Rolle als offizieller ENISA-Anbieter mit einem Vierjahresvertrag über 1,4 Millionen Euro seit Februar 2025.

Der Wachstumsmotor: NIS2, DORA und Daten-Souveränität

Die aktuelle Finanzierungsrunde wird von Elevator Ventures (Raiffeisen Bank International) angeführt und von der BMH Beteiligungs-Managementgesellschaft Hessen co-geführt. Beteiligt sind zudem eCAPITAL und Mercurius Private Equity. Dass hier vor allem Kapital mit starken Wurzeln im Finanzsektor fließt, ist strategisch logisch.

Der entscheidende Markttreiber sind die EU-Richtlinien NIS2 und DORA. Allein NIS2 erfasst europaweit über 160.000 Organisationen – davon über 30.000 in Deutschland – und führt zur persönlichen Haftung der Geschäftsführung bei Versäumnissen. Gleichzeitig fordern europäische Beschaffungsrahmen zunehmend, dass sensible Daten innerhalb der EU verbleiben. Hier zieht QuoIntelligence seinen entscheidenden Burggraben:

- Das Unternehmen ist nach deutschem Recht gegründet.

- Sämtliche Intelligence-Daten werden auf deutschem Boden unter EU-Recht gespeichert.

Die Herausforderungen

Trotz der strategisch klugen Positionierung gibt es Hürden:

- Skalierbarkeit: Das Modell setzt auf einen „Analyst-first“-Ansatz, bei dem Experten jede Information prüfen. Bei massivem Wachstum durch neue Vertriebskanäle muss die KI KARLA beweisen, dass sie diese Expert*innen effizient entlasten kann.

- Globale Konkurrenz: US-Schwergewichte wie CrowdStrike oder Mandiant verfügen über weit größere globale Daten-Netzwerke. QuoIntelligence setzt hier voll auf den Trumpf der „europäischen Souveränität“, um sich abzugrenzen.

- Mittelstands-Trägheit: Ob der Mittelstand über die reine Compliance-Erfüllung hinaus tatsächlich in tiefgehende Risiko-Intelligence investiert, wird das langfristige Wachstumstempo bestimmen.

Unser Fazit

QuoIntelligence zeigt sehr anschaulich, wie man Regulierung (NIS2/DORA) als stärksten Vertriebskanal nutzt. Die Wahl der Investor*innen aus dem Finanzsektor sichert den Zugang zur Kernzielgruppe. Mit der klaren Kante beim Datenschutz („Made in Germany“) besetzt das Start-up eine Nische, die für regulierte Unternehmen in Europa zur Pflicht wird. Gelingt der Spagat zwischen menschlicher Expertise und technischer Skalierung, könnte Frankfurt hier einen dauerhaften Champion der europäischen Cybersicherheit hervorbringen.

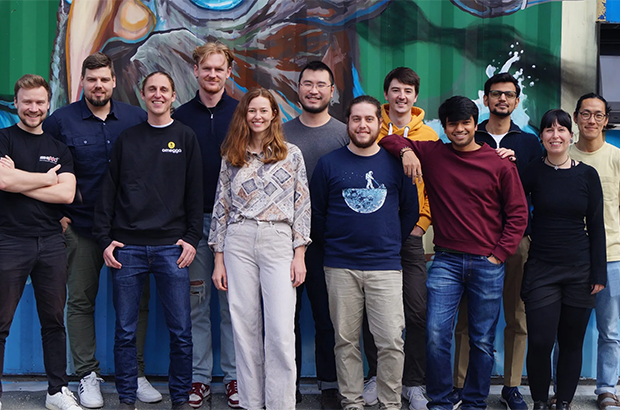

Omegga sichert 10 Mio. EUR gegen das Kükentöten

Das 2020 gegründete Münchner Start-up Omegga sichert sich Seed-Kapital für seine optische KI-Spektroskopie. Unsere Marktanalyse.

Omegga wurde 2020 von Katharina Hesseler, Till Nöllgen und Paul Günther gegründet. Zum erweiterten Gründer:innenkreis gehören zudem Moritz Eder, Kyle Hiroyasu und Clara Kaufhold. Das Team bündelt Expertise in den Bereichen KI, Optik und industrielle Systeme. In den vergangenen Jahren entwickelte das Team seine Technologie kontinuierlich vom Prototypen zum Industriestandard weiter und konnte sich bereits 2023 eine Pre-Seed-Finanzierung sowie 2024 Fördermittel des European Innovation Council (EIC) sichern.

CEO und Mitgründerin Katharina Hesseler sieht in dem Einstieg der neuen Partner, die „tiefes technologisches Verständnis mitbringen“, ein „starkes Signal für das enorme Potenzial unseres Ansatzes, einen neuen Standard in der Industrie zu setzen“. Das frische Kapital soll in den gezielten Ausbau des Teams und die kommerzielle Skalierung der Technologie fließen.

Das Problem und die technologische Lösung

Der erste und bereits kommerziell verfügbare Use Case von Omegga widmet sich einem der massivsten ethischen Probleme der modernen Landwirtschaft. Jährlich werden weltweit Milliarden männlicher Küken direkt nach dem Schlüpfen getötet, da sie weder Eier legen noch für die Masthaltung wirtschaftlich nutzbar sind.

Mit der sogenannten spektralen Intelligenz – der Kombination aus KI und Spektroskopie – will Omegga das Unsichtbare sichtbar machen. Im Gegensatz zu vielen Marktbegleitern wählt Omegga einen rein optischen, nicht-invasiven Weg. Durch spezielle Kameras und Lichtfrequenzen werden die Eier im Brutkasten gescannt. Laut eigenen Angaben bietet das Start-up damit die früheste am Markt kommerziell verfügbare Technologie, um das Geschlecht noch vor dem Schlüpfen zu bestimmen. Das System ist bereits bei Kund*innen im laufenden industriellen Produktionsbetrieb im Einsatz.

Markt, Wettbewerb & regulatorischer Druck

Der Markt für das „In-Ovo-Sexing“ wächst rasant, primär getrieben durch den Gesetzgeber. In Deutschland ist das Kükentöten seit 2022 gesetzlich verboten, Frankreich zog nach, und ein EU-weites Verbot wird debattiert. Der Zwang zur Adaption in den Brütereien ist entsprechend hoch.

Omegga tritt in ein Feld ein, das bereits von finanzstarken Konkurrenten besetzt ist:

SELEGGT: Gilt als früher Pionier auf dem Markt. Das Unternehmen nutzt hormonelle Tests am 9. Bruttag, wofür das Ei mittels eines Lasers winzig klein geöffnet werden muss (minimal-invasiv).

In Ovo: Das niederländische Unternehmen setzt auf Flüssigkeitsanalysen mittels Massenspektrometrie am 9. Bruttag und sicherte sich erst kürzlich ein 42-Millionen-Euro-Darlehen der Europäischen Investitionsbank (EIB).

Agri Advanced Technologies (AAT): Die Tochter der EW Group dominiert weite Teile des Marktes mit hyperspektraler Bildgebung, die primär für braune Eier zwischen dem 11. und 13. Tag genutzt wird.

Der entscheidende Vorteil von Omegga: Die Methode kommt völlig ohne Verbrauchsmaterialien wie Chemikalien oder feine Nadeln aus. Da die Eier bei der rein optischen Methode unversehrt bleiben, entfällt das systembedingte Kontaminationsrisiko, das bei invasiven Verfahren entstehen kann.

Unsere Einordnung

Trotz der vielversprechenden Technologie steht Omegga vor Herausforderungen:

Hardware-Skalierung in rauen Umgebungen: Die Systeme müssen in den feuchten, warmen und staubigen Inkubatoren industrieller Brütereien über Jahre hinweg wartungsarm laufen. Hier muss das Start-up beweisen, dass sich die Technologie reibungslos in den globalen Massenbetrieb integrieren lässt.

Der regulatorische „Faktor Zeit“: Rein optische Modelle benötigen oft bis zum 12. Tag für eine verlässliche Auswertung. Sollte die Politik die „Tag 6“-Frist künftig strikt durchsetzen, müssen die KI-Modelle von Omegga beweisen, dass sie derart früh hochpräzise Ergebnisse liefern.

Die Plattform-Vision – Fluch oder Segen?

Omegga positioniert seine Lösung ausdrücklich als Plattformtechnologie für die Landwirtschaft, Lebensmittelproduktion und industrielle Qualitätskontrolle. Wie stark dieses Narrativ bei den Geldgebern verfängt, zeigen die Statements zur aktuellen Runde: Laut Christian Knott (Capnamic) entsteht hier eine Technologie „mit dem Potenzial, gleich mehrere Industrien grundlegend zu verändern“. Auch Mason Sinclair (IQ Capital) lobt die Schaffung einer „Plattform für die nicht-invasive und branchenübergreifende Materialanalyse“.

Dass solche Visionen bei Investor*innen beliebt sind, da sie den adressierbaren Markt massiv vergrößern, ist nachvollziehbar. Für ein 17-köpfiges Start-up birgt die gleichzeitige Erschließung neuer Industriezweige jedoch die Gefahr einer operativen Verzettelung. Der Fokus muss zunächst darauf liegen, den Geflügelmarkt zu durchdringen.

Fazit

Gelingt es Omegga, die rein optische Methode in der Breite zu skalieren und die Genauigkeit auf die allerersten Bruttage zu trainieren, hat das Münchner Start-up einen signifikanten Hebel gegen invasiv arbeitende Wettbewerber. Die 10-Millionen-Euro-Runde ist ein klarer Vertrauensbeweis der Investor*innen in einem schwierigen Funding-Umfeld.

Energie-Betriebssystem fürs Mehrfamilienhaus: Berliner Start-up VREY sichert sich 3,3 Millionen Euro Seed-Kapital

Das Climate-Tech-Start-up VREY sammelt eine Millionenfinanzierung ein, um sich als zentrales „EnergyOS“ für Vermieter*innen zu etablieren. Doch der Markt ist umkämpft und hält operative Tücken bereit.

VREY (rechtlich firmierend unter RE Joule GmbH ) hat den Abschluss einer Seed-Finanzierungsrunde in Höhe von 3,3 Millionen Euro bekannt gegeben. Angeführt wird die Runde von Rubio Impact Ventures. Als weitere Investor*innen steigen der High-Tech Gründerfonds (HTGF) sowie der Impact-Investor Kopa Ventures ein. Das frische Kapital soll in die Skalierung des aktuell rund 20-köpfigen Teams sowie in die Weiterentwicklung der eigenen Software-Plattform fließen.

Warum PV auf Mietshäusern bisher oft scheiterte

Solaranlagen auf Einfamilienhäusern sind längst ein Erfolgsmodell, doch auf Mehrfamilienhäusern galten sie lange als operativ komplex und wirtschaftlich wenig attraktiv. Der Hauptgrund: Vermieter*innen, die ihren Mieter*innen Strom vom eigenen Dach anbieten wollten, fielen beim klassischen Mieterstrom-Modell schnell in die Pflichten eines vollwertigen Energieversorgers. Sie mussten unter anderem eine Vollversorgung garantieren – also auch dann Reststrom einkaufen und liefern, wenn die Sonne nicht schien. Komplexe Abrechnungsprozesse und teure Messtechnik schreckten zusätzlich ab.

Mit der Einführung der „Gemeinschaftlichen Gebäudeversorgung“ (GGV) entfällt ein Großteil dieser Hürden, insbesondere die Notwendigkeit für Eigentümer*innen, selbst als Energieversorger*innen aufzutreten.

VREY als „EnergyOS“

Genau auf diese regulatorische Neuerung setzt VREY. Das Start-up kombiniert eine automatisierte Abrechnungssoftware mit der Zulassung als zertifizierter Messstellenbetreiber. VREY positioniert sich damit als eine Art Betriebssystem („EnergyOS“) für die Messung, Abrechnung und Steuerung von Energieflüssen im Mehrfamilienhaus.

Die Wertschöpfung ist in der Theorie für alle Parteien lukrativ:

- Vermieter*in: Eine typische 30-kWp-Anlage auf einem Zehn-Parteien-Haus kann laut VREY rund 5.500 Euro an zusätzlichen jährlichen Einnahmen generieren.

- Mieter*in: Bewohner*innen können ihren Strom bis zu 20 Prozent günstiger beziehen, was laut Unternehmensangaben jährlichen Einsparungen von etwa 120 bis 250 Euro entspricht.

Hohes Tempo seit Gründung

Gegründet wurde VREY im Jahr 2024 von Julius Pahmeier und Cedric Jaeger. Das Tempo des Gründerduos ist beachtlich: Laut Unternehmensangaben hat VREY bereits eine dreistellige Anzahl von Projekten in allen 16 Bundesländern umgesetzt. Die Kundschaft reicht von privaten Vermietern bis hin zu großen Immobilienunternehmen und Wohnungsbaugenossenschaften.

Flaschenhälse und Konkurrenzkampf

Der adressierbare Markt für VREY ist mit über 20 Millionen potenziellen Wohneinheiten in Deutschland enorm. Doch das Start-up bewegt sich keinesfalls im luftleeren Raum.