Aktuelle Events

Anbieter-Check: Low-Code-Entwicklungs-Plattformen

Wer Softwaretools oder Webanwendungen bereitstellen will, ohne die Kosten und Mühen einer traditionellen Entwicklung per Programmiersprachen auf sich zu nehmen, kann dies mithilfe von Low-Code- oder No-Code-Entwicklungsplattformen leisten. Wir stellen sieben leistungsstarke Tools vor.

Ob für Kundenportale, Apps für die Kommunikation zwischen Shareholdern oder Lösungen zur internen Datenverwaltung: Der Bedarf an maßgeschneiderten Apps und Webanwendungen in Unternehmen ist hoch. Viele Unternehmen möchten die Entwicklung dieser Apps gern selbst in die Hand nehmen, doch längst nicht alle haben ein eigenes Entwicklungsteam mit umfassenden Programmierkenntnissen oder die Möglichkeit, Mitarbeitende in diesem Bereich zu schulen.

Hier kommen Low-Code-Entwicklungsplattformen ins Spiel: Sie bieten eine vereinfachte Entwicklungsumgebung, in der die Anwendungserstellung mithilfe visueller Elemente und nicht durch klassische textbasierte Programmiersprachen erfolgt. So kann Software deutlich schneller und auch kostengünstiger entwickelt und bereitgestellt werden, und es ist nicht nötig, Teammitglieder mit Programmierkenntnissen einzustellen oder umfangreiche Schulungen durchzuführen. Üblicherweise bieten diese Plattformen auch umfassende Funktionen zur Verwaltung von Dokumenten, Dateien und Inhalten, sodass Unternehmen mit diesen eine zentrale Informationsquelle für alle Teams erstellen können. Meist können die per Low-Code-Plattform entwickelten Anwendungen in der Cloud bereitgestellt werden, gelegentlich auch On-Premises.

Die von uns ausgewählten Anbieter*innen bieten unter anderem folgende drei Hauptfunktionen von Low-Code-Plattformen: Deployment Management (Einsatzmanagement), Integrations Management (Integrationsmanagement) und Visual Modeling (visuelle Gestaltung). Sämtliche Auswahlkriterien sind am Ende des Beitrags aufgeführt. Die sieben Tools sind in alphabetischer Reihenfolge aufgeführt.

Airtable

Die Low-Code-Entwicklungsplattform Airtable verbindet die vertraute Nutzungsweise von Tabellenkalkulationen mit den Möglichkeiten einer Datenbank. Teams können Daten aus den unterschiedlichsten Quellen automatisch und in Echtzeit synchronisieren und so eine zentrale Informationsquelle für alle Beteiligten schaffen. Diese Daten lassen sich in sogenannten Bases in Tabellenform oder in zahlreichen anderen Ansichten anzeigen, etwa als Gantt-Diagramm, Kanban-Board, Teamkalender, visuelle Galerie oder Zeitleiste. Auch teilbare Formulare zum Erfassen von Daten sind verfügbar. Teams können Prozesse und Abläufe automatisieren, von einfachen automatisch versendeten Benachrichtigungen bis hin zu komplexen mehrschrittigen Workflows, und sich dabei die Integrationen für Tools wie Google Workspace, Slack oder Twitter zunutze machen. Die Logiken für die Automatisierung lassen sich per JavaScript erweitern.

Mit dem Interface Designer von Airtable können Teams per Drag and Drop und ohne Code eigene Nutzungsoberflächen erstellen und Berechtigungen dafür festlegen, wer worauf Zugriff hat. Für jede Base lassen sich beliebig viele Oberflächen erstellen und für einzelne Teammitglieder oder Stakeholder individuell anpassen. Die cloudbasierte Lösung ist über den Browser sowie als Desktop-App für Mac und Windows und als iOS- oder Android-App nutzbar.

Für Einzelpersonen oder sehr kleine Teams bietet Airtable eine Gratisversion mit unbegrenzt vielen Bases und bis zu 1200 Datensätzen pro Base für bis zu fünf Teammitglieder. In den kostenpflichtigen Versionen Plus, Pro und Enterprise sind unter anderem Erweiterungen verfügbar (drei bzw. zehn pro Base in den Versionen Plus und Pro, unbegrenzt viele in der Enterprise-Version), mit denen sich die Bases beispielsweise um einen JSON-Editor, interaktive Skripts, Suchfunktionen und einen CSV-Import erweitern lassen. Die Enterprise-Version bietet großen Unternehmen nützliche Funktionen wie einen dreijährigen Revisionsverlauf, Single Sign-On und ein unternehmensweites Admin-Panel.

5 Hauptfunktionen von Airtable

- Cloudbasiertes Unternehmens-Dashboard als zentrale Informationsquelle.

- Automatisierungen mit den verschiedensten Auslösern einschließlich Webhooks.

- Flexibel anpassbare Ansichten und Freigabeeinstellungen.

- No-Code-/Low-Code Entwicklung von Anwendungen, die als Website bereitgestellt werden können.

- Integrationen für zahlreiche beliebte Anwendungen wie GitHub, Asana oder Zendesk; Zapier-Integrationen und REST API.

BIC Platform

Die BIC Platform bietet eine Reihe verschiedener Module zur Erreichung der Unternehmensziele: BIC Process Design dient der Modellierung, Analyse und Optimierung von Unternehmensprozessen einschließlich automatisierter Prüf- und Freigabe-Workflows sowie Dokumentenmanagement. BIC Information Security ist ein automatisiertes Informationssicherheitsmanagementsystem nach ISO 27001 mit interaktiven Dashboards, vordefinierten Berichten und Risikomanagement. BIC Data Protection hilft Unternehmen, die Vorgaben der DSGVO einzuhalten. BIC Business Continuity hilft bei der Überwachung kritischer Geschäftsprozesse und der Reaktion im Notfall, BIC BSI Grundschutz dient der Einhaltung der Anforderungen des BSI (Bundesamt für Sicherheit in der Informationstechnik) und die GRC-Software BIC Custom GRC verwaltet Prozesse zu Governance, Risk und Compliance.

BIC Process Execution bietet zahlreiche Funktionen für die Low-Code-/No-Code-Automatisierung. Per Drag-and-DropModellierung und Formulareditor im Baukastensystem lassen sich ausführbare Workflows, digitale Formulare oder durch Bots automatisierte Aufgaben etwa für Kund*innen oder Mitarbeitende erstellen. Dabei können Drittsysteme wie SAP, Microsoft Dynamics, Sharepoint und Salesforce integriert werden und Robotic Process Automation erweitert die Automatisierung.

Der Anbieter hat seinen Hauptsitz in Bochum: Das Tool und der Kundensupport sind somit auf Deutsch verfügbar. Alle Preisinformationen sowie eine kostenfreie Demo oder Testversion gibt es auf Anfrage.

5 Hauptfunktionen von BIC Platform

- Prozessoptimierung und -automatisierung.

- Module für Informationssicherheit, Datenschutz, Compliance und mehr.

- Prozess-Templates für die einfache No-Code-/Low-Code-Automatisierung.

- Dynamisches Fall- und Aufgabenmanagement.

- Analysen von Prozessperformance und Fortschritt.

Formaloo

Mit Formaloo können Unternehmen ohne Verwendung von Code Formulare, Datenbanken und benutzerdefinierte Webanwendungen erstellen. Dabei können sie Daten aus Excel-Tabellen importieren, über in Formaloo erstellte Onlineformulare erfassen oder Datensätze neu aufbauen. Der auf die Zusammenarbeit ausgerichtete Arbeitsbereich kann nach verschiedenen Teams, Abteilungen, Kund*innen und Projekten organisiert werden. Im Web App Builder lassen sich Formulare, Links, Tabellen, Diagramme und mehr zusammenführen, um die Daten an einem zentralen Ort zu visualisieren, zu verwalten und mit anderen zu teilen. Per iframe können die so erstellten Web-Apps in Websites eingebettet werden. Auch vorgefertigte Templates für Web-Apps sind verfügbar. Neben zahlreichen Integrationen für Apps und Services wie Google, Salesforce, Microsoft oder Shopify gibt es eine SDK, APIs und Webhooks.

Die kostenlose Version von Formaloo richtet sich an Einzelpersonen mit bis zu fünf Datenbanken und Anwendungen. Für KMU eignet sich die Plus-Version mit unbegrenzt vielen Datenbanken und Anwendungen, größere Unternehmen sind mit der Pro- oder Enterprise-Version gut bedient. Ab der Plus-Version sind Workflow-Automatisierung und Logiken verfügbar.

5 Hauptfunktionen von Formaloo

- Erstellen von Formularen, Datenbanken und Webanwendungen.

- Anwendungsvorlagen für die verschiedensten Bereiche.

- Datenerfassung und -analyse, etwa für Kundendaten.

- Zugriffsbeschränkungen und sichere Zusammenarbeit im Team.

- WordPress-Plugin zum Erstellen von Formularen und Widgets.

Forms On Fire

Wie der Name schon verrät, liegt ein Fokus von Forms on Fire auf der Erstellung von Formularen. Das Tool richtet sich unter anderem an Unternehmen, die Formulare für ihre internen und externen Mitarbeitenden erstellen möchten, etwa für Inspektionen, Fragen zur Arbeitssicherheit oder Arbeitsaufträge. Doch auch mobile Datenbanken, Referenzdokumente, Aufgabenlisten und Analyseberichte können erstellt werden. Sowohl die Datenerfassung als auch das Ausdrucken von Inhalten sind offline möglich und die No-Code-Designs können in Excel exportiert werden. Zu den nutzbaren Funktionen gehören Barcode- und NFC-Scans, Signaturerfassung, GPS-Standorterfassung und die Integration in andere Systeme.

Das Tool ist in den Versionen Standard, Premium und Enterprise verfügbar. Alle drei Versionen bieten unbegrenzten Speicherplatz und unbegrenzt viele Apps. Die Premium-Version bietet zudem Workflows, unbegrenzt viele Einträge und Premium-Konnektoren. Die Enterprise-Version ermöglicht Single Sign-On und bietet SYNQL für MS SQL oder MySQL.

5 Hauptfunktionen von Forms On Fire

- Plattformübergreifende Formularerstellung und Excel-App-Designer.

- Versionskontrollen und Testmodus für mobile Apps.

- Benutzer*innendefinierte Dashboards für die grafische Aufbereitung von Informationen.

- Automatisierungen mit flexiblen Workflows, Aufgaben-Templates und Aufgaben-API.

- Integrationen für Google Sheets, Amazon S3, SharePoint, PowerBI, Zapier und mehr sowie offene API.

Intrexx

Intrexx ist ein skalierbares Low-Code-Baukastensystem für individuell erstellte Businessanwendungen. Per Drag and Drop lassen sich Anwendungen erstellen und Workflows automatisieren, um beliebige Arbeitsabläufe im Unternehmen zu optimieren. Intrexx bietet zahlreiche branchenunabhängige, vorgefertigte Softwarelösungen, die an die individuellen Bedürfnisse eines Unternehmens angepasst werden können, etwa für das Risikomanagement, die Datenanalyse, das Customer Relationship Management, das Qualitätsmanagement oder die Prozessvisualisierung.

Für den Einstieg bietet Intrexx eine Auswahl an Schulungen über die Intrexx Academy, sowohl als On-Demand-Videotrainings als auch als geführte Onlineschulungen zu festen Terminen. Unternehmen können zudem individuelle Onlineschulungen für ihre Teams buchen. Zu den Tools von Intrexx gehören außerdem das DMS-System Dokumentenmanager Pro sowie das Tool für die interne Zusammenarbeit Intrexx Share, das auch Projekt- und Aufgabenmanagementfunktionen bietet.

Das Tool wird in Deutschland entwickelt, ist auf Deutsch verfügbar und bietet eine 90-tägige Testversion sowie ein persönlich begleitetes Onboarding. Preise sowie persönliche telefonische Beratungstermine sind auf Anfrage verfügbar.

5 Hauptfunktionen von Intrexx

- Anpassbare Businessanwendungen für viele Bereiche.

- Low-Code-Plattform mit Drag-and-Drop-Editor.

- Dokumentenmanager und Zusammenarbeitstool.

- Prozessautomatisierung mit digitalen Workflows.

- Zentrale Darstellung aller Unternehmensprozesse.

Ninox

Mit der cloudbasierten Datenbankplattform Ninox können Unternehmen Daten und Dokumente an einem zentralen Ort verwalten, über beliebige Geräte zusammenarbeiten und per Drag and Drop Formulare, Berichte und Business-Anwendungen in beliebiger Komplexität erstellen. Daten können in Formularen verwaltet und als Tabelle, Diagramm, Karten, Kanban-Board, Gantt-Diagramm oder Pivot-Diagramm angezeigt werden. Die Automatisierung ist skriptbasiert und über Trigger möglich, ferner es gibt eine breite Auswahl an Vorlagen, etwa für Vertrags- oder Aufgabenverwaltung, Wartungs-, Abnahme- oder Mängelprotokolle, die Arbeitszeiterfassung, das On- und Offboarding, CRM oder Immobilienverwaltung. Für mehr Sicherheit sind rollenbasierte Zugriffsberechtigungen, benutzer*innendefinierte Passwortrichtlinien, Sitzungsmanagement und Single Sign-on verfügbar.

Ninox ist ein deutsches Tool, somit auf Deutsch verfügbar und DSGVO-konform. Wer nur kleine Business-Anwendungen erstellen möchte, kann bereits in der Starter-Version unbegrenzte Arbeitsbereiche, Datenbanken und Tabellen sowie skriptbasierte Automatisierungen nutzen. In der Professional-Version gibt es Anwender*inrollen, rollenbasierte Zugriffsberechtigungen und zusätzliche Ansichten, in der Enterprise-Versionen unter anderem SSO, AD DS (Active Directory Domain Services), Personalisierungsoptionen sowie die Möglichkeiten zur Bereitstellung in einer privaten Cloud oder On-Premises statt in einer öffentlichen Cloud. Zudem gibt es Apps für iPhone, iPad, Android und Mac.

5 Hauptfunktionen von Ninox

- Cloudbasierte Datenverwaltung, Formular- und Berichtserstellung.

- No-Code-Erstellung von benutzer*innendefinierten Anwendungen.

- Vordefinierte Feldtypen und Vorlagenbibliothek.

- HTTP/REST-APIs, Integrationen einschließlich Zapier und Make (ehemals Integromat).

- Zugriffsberechtigungen und Sitzungsmanagement.

Softr

Softr dient dazu, benutzer*innendefinierte Unternehmensanwendungen wie Kundenportale, Partneranwendungen oder interne Tools auf Basis der Daten aus Airtable-Bases oder Google-Tabellen zu erstellen. Dafür stehen mehr als 100 vordefinierte Blöcke wie etwa Funktionsübersichten, Formulare und CTAs für Websites zur Verfügung und die so entwickelten Full-Stack-Webanwendungen können Mitgliedschaften, Zahlungen und Geschäftslogiken unterstützen sowie für Apple- und Android-Geräte bereitgestellt werden. Die Sichtbarkeit von Seiten und Blöcken ist einzeln einstellbar, etwa abhängig von Bedingungen wie dem Anmeldestatus von Personen, deren Nutzer*innenrolle oder aktuellem Abonnement. Mit Softr entwickelte Websites können auf eigenen Domains gehostet werden und sind SEO-optimiert. Seitenelemente können interaktiv hinzugefügt und bearbeitet werden, beispielsweise Profilinformationen. Neben der direkten Airtable-Integration sind Integrationen für Google Analytics, Stripe, Mailchimp und mehr sowie Integrationen per Zapier und Make (Integromat) verfügbar.

Es gibt eine Gratisversion für unbegrenzt viele Anwendungen, eine benutzer*innendefinierte Domain mit Softr-Branding und Airtable-Integration für bis zu 200 Datensätze. Die kostenpflichtigen Versionen Starter, Professional und Business richten sich an unterschiedlich große Unternehmen und bieten je nach Version zusätzliche Funktionen wie benutzer*innendefinierter Code (HTML/CSS/JavaScript), das Aktualisieren von Airtable-Datensätzen sowie die Option, Mitgliedschaften und Paywalls für – je nach Version – bis zu 100.000 Mitglieder einzurichten.

5 Hauptfunktionen von Softr

- Entwicklung von Unternehmensanwendungen auf Basis von Airtable oder Google-Tabellen.

- Bereitstellung von Websites mit Mitgliedschaften, Paywalls und Zahlungsfunktionen.

- Vorgefertigte Blöcke zur Erstellung interaktiver Webanwendungen.

- Aktualisieren von Airtable-Datensätzen.

- Integrierte SEO-Funktionen.

Methodik

Für diese Liste haben wir zunächst Tools ausgewählt, die innerhalb der letzten zwei Jahre mindestens 20 Nutzer*innenbewertungen auf Get App erhalten haben (Stand vom 29.09.2022). Anschließend wurden diese Tools nach der Reihenfolge ihrer Gesamtbewertung (von der höchsten bis zur niedrigsten) sortiert, wobei wir eine Mindestbewertung von 4,5 von 5 Sternen zugrunde gelegt haben. Außerdem mussten die Produkte unserer Definition von Low-Code-Plattformen entsprechen: Low-Code-Entwicklungsplattformen bieten Nutzer*innen eine vereinfachte Entwicklungsumgebung, in der die Anwendungserstellung mithilfe visueller Elemente und nicht durch traditionelle Kodierung erfolgt. Die Softwareprogramme mussten ebenfalls die Hauptfunktion der Kategorie Low-Code-Software bieten: Deployment Management (Einsatzmanagement), Integrations Management (Integrationsmanagement) und Visual Modeling (Visuelle Gestaltung). Die finale Auswahl setzt sich aus den ersten sieben Tools zusammen, die alle oben stehenden Kriterien erfüllen.

Die Autorin Rosalia Pavlakoudis ist Content Analyst für GetApp und Software Advice, zwei unabhängigen Software-Vergleichsplattformen für Business-Software-Käufer*innen. Beide Netzwerke bieten verifizierte Nutzerbewertungen und unabhängige Testberichte in Hunderten von Softwarekategorien.

Diese Artikel könnten Sie auch interessieren:

Produktivität statt Überstunden: Wie Echtzeitdaten das Finanzwesen von morgen steuern

Das KI-gestützte Fintech Embat beendet das Excel-Chaos im Treasury und macht Finanzteams mit Echtzeitdaten fit für die Zukunft.

Berlin, 28. April 2026 – Es ist ein bekanntes Bild in den Finanz- und Treasury-Abteilungen des deutschen Mittelstands: Wenn der Monatsabschluss naht oder Ad-hoc-Berichte für die Geschäftsführung benötigt werden, bleiben die Schreibtischlampen bis spät in die Nacht an. Die manuelle Zusammenführung von Daten aus unterschiedlichen Bankportalen und historisch gewachsenen Excel-Listen kostet nicht nur Nerven, sondern vor allem wertvolle Zeit.

Das schnell wachsende Fintech Embat tritt an, um genau diesen Engpass aufzulösen. André Reimers, Head of DACH, treibt diese Mission im deutschsprachigen Raum als Gesicht des Unternehmens voran. Seine Kernüberzeugung: Wer heute noch regelmäßig Überstunden machen muss, um finanzielle Transparenz zu schaffen, leidet nicht unter mangelnder Einsatzbereitschaft – er leidet unter einem strukturellen Datenproblem.

Beeindruckendes Wachstum durch das Lösen echter Pain Points

Dass der Schmerz in den Finanzabteilungen groß und der Bedarf an modernen Lösungen riesig ist, belegen die Zahlen, mit denen Embat den europäischen Markt aufrollt. Mit einem starken Kundenwachstum im deutschen Markt von über 250 Prozent im vergangenen Jahr und mittlerweile mehr als 400 mittelständischen und großen Unternehmenskunden weltweit hat sich das Fintech als fester Player etabliert. Das stetig wachsende Transaktionsvolumen von 250 Millionen Euro zeigt deutlich: Der Wechsel von fehleranfälligen Tabellen zu automatisierten Cloud-Lösungen ist in vollem Gange.

Der Weg aus der Excel-Falle

Mit seiner Technologie nimmt Embat den Kampf gegen ineffiziente Prozesse im Treasury auf. Anstatt hochqualifizierte Mitarbeiter mit repetitiver Datenpflege zu binden, automatisiert das System die Konsolidierung aller relevanten Finanzdaten.

„Die Erwartungshaltung, dass komplexe Finanzanalysen zwingend mit langen Abenden im Büro einhergehen müssen, ist schlichtweg nicht mehr zeitgemäß“, erklärt André Reimers. „Wenn Cashflow, Liquidität und Runways per Knopfdruck in Echtzeit abrufbar sind, ändert sich die gesamte Arbeitsdynamik. Finanzteams können aus dem reaktiven Modus heraustreten und sich auf die strategische Steuerung des Unternehmens konzentrieren.“

Hohe Innovationskraft trifft auf lokales DACH-Verständnis

Embat profitiert von einer enormen Innovationsgeschwindigkeit und Agilität, auf der die starke technologische Basis des Unternehmens beruht. Wie diese passgenau auf die spezifischen Bedürfnisse des deutschen Marktes übersetzt wird und für eine hohe lokale Marktpräsenz sorgt, zeigt André Reimers an den Standorten in München und Berlin.

Von diesen beiden Standorten aus steuert André Reimers das DACH-Geschäft und stellt das tiefe Verständnis für die komplexen Strukturen und hohen Sicherheitsbedürfnisse des deutschen Mittelstands sicher. Das Team zeigt dabei, wie moderne, dezentrale Zusammenarbeit erfolgreich funktioniert. Das Vertrauen der stetig wachsenden deutschen Kundenbasis fußt dabei auf dieser geballten lokalen Expertise gepaart mit der unerschütterlichen Zuverlässigkeit der Systeme.

Führen durch Resultate, nicht durch Anwesenheit

Die Botschaft an die Finanzwelt ist klar: Moderne Führung, hohe Produktivität und Skalierbarkeit erfordern keine starren Kontrollmechanismen oder endlosen Arbeitstage. Sie erfordern radikale Datentransparenz und die richtigen digitalen Werkzeuge. Wenn die Daten in Echtzeit fließen, sinkt die Fehlerquote, die Entscheidungsgeschwindigkeit steigt – und die systembedingten Überstunden im Treasury gehören endgültig der Vergangenheit an.

Über Embat:

Embat ist ein KI-gestütztes FinTech mit Schwerpunkt auf Treasury-Management, das es mittelständischen Unternehmen und Großkonzernen ermöglicht, ihre Finanzprozesse in Echtzeit zu zentralisieren. Gegründet von Antonio Berga und Carlos Serrano – ehemaligen J.P. Morgan-Managern mit umfassender Erfahrung im Corporate Banking – sowie Tomás Gil, dem ehemaligen CTO von Fintonic, entstand die Plattform mit der Mission, die Finanzabteilung zu digitalisieren. Die klare Prämisse dabei: Technologie von Finanzexperten für Finanzexperten.

Durch seine hybride Konnektivität lässt sich Embat in über 15.000 Banken und führende ERP-Systeme integrieren und beseitigt so jegliche Datenfragmentierung. Das wichtigste Alleinstellungsmerkmal ist TellMe, ein „Agentic Treasury Analyst“ (autonomer KI-Analyst), der Cashflow-Muster erkennt, komplexe Kontenabstimmungen automatisiert und strategische Entscheidungen zur Optimierung der Liquidität vorschlägt.

Mit Niederlassungen in Madrid, London, Berlin und München definiert Embat die Zukunft des Corporate Finance neu.

Stallgrün: Mit Hightech-Kräutern gegen den Agrar-Strukturwandel

Leere Ställe als Chance: das 2023 von Judith Ryll und Thorsten Lansmann-Niehaus gegründete Stallgrün nutzt Bestandsbau für Indoor Farming. Wir checken das Modell hinter der aktuellen 125.000-€-DBU-Förderung.

Der Strukturwandel in der deutschen Landwirtschaft ist unaufhaltsam: Allein zwischen 2013 und 2023 ging die Zahl der hiesigen Betriebe mit Schweinehaltung um 44 Prozent zurück, wie Zahlen des Bundesministeriums für Ernährung und Landwirtschaft (BMEL) belegen. Jedes Jahr geben Landwirt*innen auf. Zurück bleiben leere Ställe – und Landwirtschaftsbetriebe auf der Suche nach neuen finanziellen Perspektiven.

Das 2023 in Münster gegründete Start-up Stallgrün will aus diesen „Stranded Assets“ einen lukrativen Zukunftsmarkt formen: Indoor Farming im ehemaligen Schweinestall. Die Deutsche Bundesstiftung Umwelt (DBU) unterstützt das Projekt aktuell mit 125.000 Euro im Rahmen ihrer Green Startup-Förderung. Wir wollten wissen: Wie tragfähig ist das Modell jenseits der Fördergelder wirklich?

Die Köpfe hinter der Idee & die Historie

Hinter Stallgrün stehen die Gründer Judith Ryll und Thorsten Lansmann-Niehaus. Ryll bringt als Biowissenschaftlerin tiefe Expertise in der Pflanzenbiologie mit, während Lansmann-Niehaus – der bezeichnenderweise selbst auf einem Schweinemastbetrieb aufwuchs – die kaufmännische Führung übernimmt. Gefördert durch regionale Inkubatoren wie das Seedhouse, hat das Duo den technologischen Machbarkeitsnachweis bereits erbracht: In den vergangenen zwei Jahren wurde das Konzept auf einer Pilotfarm erfolgreich entwickelt.

Das Geschäftsmodell: Mehr als nur Hardware

Die Grundprämisse ist so simpel wie pragmatisch: Ehemalige Schweineställe sind in der Regel massiv gebaut sowie gut isoliert und bieten damit architektonisch ideale Bedingungen für den ganzjährigen Anbau von regionalen Kräutern und Gemüse. Stallgrün positioniert sich als B2B-Technologie- und Service-Provider für Höfe im Wandel und will deutschlandweit agieren. Das System fußt auf drei wesentlichen Säulen:

- Automatisierte Anlagentechnik: Als Kernprodukt hat das Start-up während der DBU-Förderung eine Anlage entwickelt, welche die Bewässerung, Düngung, Belichtung und Klimatisierung automatisiert steuert.

- Datengetriebene Agrar-Software: Ergänzend liefert das Team spezifische Anbauprotokolle für die teilnehmenden Betriebe. Für geeignete Kulturen wurde der optimale Einsatz von Parametern wie Saatgut, Erde, Dünger, Licht und Bewässerungszyklen definiert.

- B2B-Ökosystem: Um die Einstiegshürde zu minimieren, hat Stallgrün einen Materialhandel für passendes Anbaumaterial aus einer Hand aufgebaut und bietet rechtliche Hilfen bei der Verwaltung an. Zudem unterstützt das Start-up beim Aufbau der Vermarktung.

Stallgrün versteht sich dabei nicht als Feind der traditionellen Landwirtschaft. Laut Lansmann-Niehaus ist Indoor Farming kein Ersatz für den etablierten Freiland- oder Gewächshausanbau, sondern eine wetter- und klimaunabhängige Ergänzung.

Die Vision: Produkte sollen ganzjährig regional verfügbar gemacht werden. Die vermehrte Nutzung regionaler Lebensmittel anstelle von Importen reduziere zudem den Transportaufwand und die daraus entstehenden Emissionen.

Kritische Markteinordnung

Der Markt für Vertical- und Indoor-Farming ist ein hartes Pflaster. Prominente Branchenvorreiter wie das ehemals hochgelobte Berliner Start-up Infarm haben in der Vergangenheit massiv Risikokapital verbrannt, weil die schiere Skalierung von energieintensiven Hightech-Farmen in urbanen Ballungsräumen betriebswirtschaftlich oft zum Scheitern verurteilt war.

Hier liegt der geniale, aber auch kritische Hebel von Stallgrün: Anstatt teure Gewerbeimmobilien anzumieten, nutzt das Team bestehende, ländliche Infrastruktur. Das verhindert eine zusätzliche Versiegelung von Flächen, was auch DBU-Generalsekretär Alexander Bonde als zentralen ökologischen Faktor hervorhebt. Ein weiterer Wettbewerbsvorteil: Viele Höfe verfügen bereits über großflächige Photovoltaikanlagen auf ihren Stalldächern. Damit lässt sich der enorme Strombedarf für die Belichtung und Klimatisierung teilweise direkt durch eigenen, günstigen Sonnenstrom abdecken.

Dennoch bleiben aus unserer Sicht drei gravierende Hürden für das Geschäftsmodell:

- CAPEX-Intensität: Die Umrüstung eines leeren Stalls in eine funktionsfähige Hightech-Anlage ist extrem kapitalintensiv. Es bleibt fraglich, wie Landwirte, die gerade aus der unprofitablen Schweinehaltung ausgestiegen sind, das nötige Investitionskapital für diesen Hardware-Neustart bei ihren Banken abrufen können.

- Radikaler Kulturwandel: Einen traditionellen Schweinemäster in einen agilen, datengetriebenen Indoor-Kräuterproduzenten zu transformieren, erfordert enormen Beratungs- und Change-Management-Aufwand seitens Stallgrün.

- Wettbewerb & Margendruck: Die teilnehmenden Bauern und Bäuerinnen kämpfen letztlich gegen die extrem knappen Margen des Lebensmitteleinzelhandels.

Unser Fazit

Stallgrün liefert einen erfrischend bodenständigen „Hardware-meets-Agrar“-Ansatz in einem Tech-Segment, das lange Zeit von utopischen, rein urbanen Vertical-Farming-Träumereien dominiert wurde. Durch die kluge Umnutzung von Infrastruktur-Altlasten und die clevere Kombination aus Hardware, Software-Protokollen und einem integrierten B2B-Serviceangebot hat das Duo ein System aufgebaut, das ein hohes Skalierungspotenzial besitzt.

Die DBU-Förderung von 125.000 Euro ist ein sauberes Validierungssignal für den positiven ökologischen Impact der Gründer*innen. Die wahre Reifeprüfung wird nun jedoch in den Bilanzen der kooperierenden Landwirte stattfinden: Nur wenn die Höfe durch den automatisierten Anbau zügig ihre hohen Anfangsinvestitionen amortisieren können, wird aus dem Münsteraner Pilotprojekt ein neuer bundesweiter Agrar-Standard. Ein mutiger Pivot für die heimische Landwirtschaft – und ein Start-up, das man als Investor*in und Beobachter*in der Agrar-Wende unbedingt auf dem Zettel haben sollte.

5 Mio. Euro für die „Schreibtischlosen“: Kann Elephant den Frontline-Markt wirklich digitalisieren?

Operative Teams in der Produktion, der Logistik oder im Service gelten bei der Digitalisierung oft als vernachlässigt. Das Berliner Start-up Elephant verspricht Abhilfe durch KI-gestütztes Micro-Learning und sicherte sich dafür nun 5 Millionen Euro. Doch zwischen dem PR-Versprechen und der harten Shopfloor-Realität warten ein eng besetzter Markt und die Gefahr der technologischen Austauschbarkeit.

Die aktuelle Finanzierungsrunde wird von den Corporate-Venture-Capital-Einheiten (CVC) EnBW New Ventures und Wepa angeführt. Dass ausgerechnet diese Player investieren, ist kein Zufall: Die Mutterkonzerne steuern selbst riesige operative Belegschaften. Sie dienen der Elephant Technologies GmbH somit nicht nur als Geldgeber, sondern gleichzeitig als Testlabor und Referenzkund*innen. Ergänzt wird die Runde durch namhafte Angel-Investoren aus dem Umfeld von Flix und Home24.

Das Geschäftsmodell: KI-Kurse gegen das „Wissens-Leck“

Die Gründer Maurice Zomorrodi, Niklas Dehio und Melchior Schramm riefen Elephant im Sommer 2022 ins Leben. Sie adressieren ein strukturelles Problem: Wissen wird in operativen Betrieben oft noch mündlich oder über veraltete Handbücher weitergegeben. Die Elephant-Plattform nutzt einen KI-gestützten „Coursebuilder“, um aus bestehenden Dokumenten mit wenigen Klicks interaktive Lerneinheiten für eine mobile App zu generieren. Ein KI-Assistent soll Fragen zudem kontextbezogen direkt am Arbeitsplatz beantworten. Um Sprachbarrieren in der Industrie abzubauen, bietet das System Übersetzungen in über 95 Sprachen. Dass das Modell Anklang findet, zeigt sich am Solar-Einhorn Enpal, das Elephant zur Schulung von Quereinsteigern nutzt.

Journalistisch betrachtet muss man jedoch das Preisschild hinterfragen: Der Einstieg in die Plattform beginnt bei 640 Euro monatlich für bis zu 50 Nutzer*innen („Team“) und skaliert über 1.300 Euro („Pro“) bis hin zu Enterprise-Lösungen ab 4.000 Euro im Monat. Für Mittelständler*innen ist das ein beachtlicher Kostenblock, der sich zügig durch messbar sinkende Fehlerquoten oder kürzere Onboarding-Zeiten rechtfertigen muss.

Ein Markt im Goldrausch: Wer sind die Jäger*innen?

Elephant ist längst nicht allein auf der Jagd nach der „Deskless Workforce“. Dieses enorme Segment hat in den letzten Jahren mächtige Wettbewerber auf den Plan gerufen. So hat beispielsweise der Branchen-Riese Beekeeper die Frontline-Trainingsplattform eduMe nahtlos in seine App integriert, um Mitarbeitenden Weiterbildung mit nur einem Klick zugänglich zu machen. Solche Konsolidierungen zeigen: Der Standard im operativen Weiterbildungsmarkt wird zunehmend höher.

Zwischen Innovation und Commodity

Trotz des Kapitalschubs steht das Start-up vor zwei entscheidenden Hürden. Erstens droht der technologische Kern – das Umwandeln von PDFs in Quizze mittels KI – zu einer reinen „Commodity“ zu werden. Da große Sprachmodelle (LLMs) rasant mächtiger werden, könnten generische Unternehmenstools diese Funktion bald als Standard-Feature mitliefern. Elephant muss beweisen, dass sich die Plattform unverzichtbar tief in echte Qualitätssicherungs- und Produktionsprozesse verwebt.

Zweitens bleibt der Faktor Mensch das größte Risiko. Software für den Shopfloor scheitert selten am Management, sondern oft an der fehlenden Akzeptanz der Belegschaft. Wenn die App im stressigen Arbeitsalltag nicht als spürbare Entlastung wahrgenommen wird, nützt auch die beste KI wenig.

Unser Fazit

Ein valider Ansatz unter hohem Konkurrenzdruck Elephant hat mit EnBW und Wepa die idealen Partner gefunden, um die Praxistauglichkeit in großen Strukturen unter Beweis zu stellen. Die 5 Millionen Euro geben den nötigen Runway. Dennoch ist der technologische Burggraben schmal. Um langfristig gegen internationale Schwergewichte zu bestehen, muss Elephant mehr sein als nur ein komfortabler Content-Generator. Der echte Härtetest beginnt an der Werkbank.

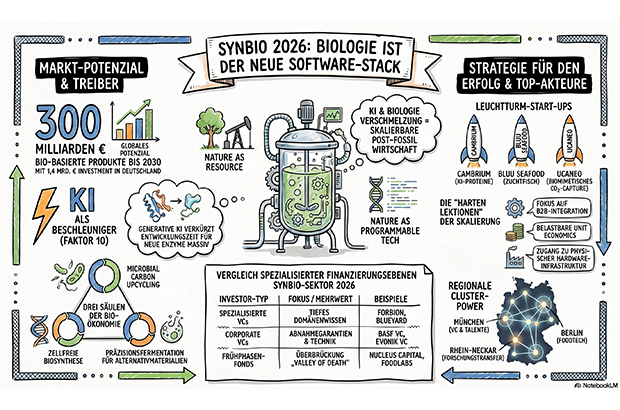

SynBio-Start-up-Report 2026

Biologie ist der neue Code: Wie Synthetische Biologie (SynBio) die Industrie neu programmiert und welche Start-ups dabei hierzulande federführend sind.

Die Vision einer post-fossilen Wirtschaft ist im Jahr 2026 keine bloße Utopie mehr, sondern eine präzise Ingenieursleistung. Wir erleben den Moment, in dem die Natur von einer Ressource, die wir ausbeuten, zu einer Technologie wird, die wir programmieren. In den Laboren der Republik entstehen heute Lösungen für die größten Versorgungskrisen unserer Zeit. Der Aufstieg der Synthetischen Biologie (SynBio) markiert den Übergang vom Zeitalter der Petrochemie in das Zeitalter der Biomanufaktur – eine Transformation, die so tiefgreifend ist wie die industrielle Revolution, jedoch mit der Geschwindigkeit der digitalen Transformation erfolgt.

Wenn Bits auf Atome treffen

Der SynBio-Markt ist 2026 in eine Phase der industriellen Skalierung eingetreten. Aktuelle Analysen der KfW sowie Branchenberichte von BCG beziffern das globale Marktpotenzial für bio-basierte Produkte bis Ende des Jahrzehnts auf über 300 Milliarden Euro. Allein in Deutschland ist das Investitionsvolumen in DeepTech-BioTech-Start-ups im vergangenen Geschäftsjahr laut Bitkom-Daten auf einen Rekordwert von 1,4 Milliarden Euro gestiegen. Der entscheidende technologische Katalysator ist die Verschmelzung von Generativer KI und Biologie. Dank Modellen, die Proteinfaltungen präziser vorhersagen können, als es je ein menschlicher Forscher vermochte, wurde die Entwicklungszeit für neue Enzyme um den Faktor zehn verkürzt. Die Biologie wird damit endgültig zum „Software-Stack“, bei dem Design-Build-Test-Learn-Zyklen in digitalisierten Bio-Gießereien automatisiert ablaufen.

Jenseits der Petrischale: Die Treiber der Bio-Ökonomie

Drei spezifische Sub-Sektoren dominieren in diesem Jahr die Agenda der Investor*innen. An erster Stelle steht die zellfreie Biosynthese, bei der komplexe Moleküle ohne den Einsatz lebender Zellen produziert werden, was die Skalierbarkeit massiv erhöht. Pioniere wie das US-Unternehmen Solugen haben hier den Weg geebnet, doch deutsche Akteure ziehen in der Effizienz der Bioreaktor-Steuerung nach. Ein zweiter massiver Treiber ist das Microbial Carbon Upcycling: Mikroben werden so programmiert, dass sie industrielles CO2 direkt in hochwertige Proteine oder Kunststoffe umwandeln. Hier verschmelzen Klimaschutz und Produktion zu einer Einheit. Drittens sehen wir den Siegeszug der Biomanufaktur bei Alternativmaterialien – sei es durch Biomasse-Fermentation für Lederersatz aus Myzel oder durch echte Präzisionsfermentation, bei der etablierte Akteure wie die bayrische AMSilk zeigen, dass programmierte Spinnenseide-Proteine bereits in Serie gehen können. Die Lieferkette der Mode- und Automobilindustrie wird durch diese Biopolymere radikal dekarbonisiert.

Die harten Lektionen der Skalierung

Der Weg zum Erfolg war jedoch von schmerzhaften Rückschlägen gepflastert. Der prominente Crash des einstigen Branchenlieblings Amyris im Jahr 2023 wirkt bis heute als warnendes Beispiel nach. Das Unternehmen scheiterte trotz Milliardenbewertung an der Komplexität der vertikalen Integration und dem Versuch, gleichzeitig Technologieplattform und B2C-Marke zu sein. Für heutige Gründer*innen haben sich daraus vier fatale Fallstricke herauskristallisiert, die über Sieg oder Niederlage entscheiden. Erstens: Die Ignoranz gegenüber den Unit Economics. Ein Produkt, das im 5-Liter-Maßstab funktioniert, muss im 50.000-Liter-Kessel nicht zwangsläufig profitabel sein. Zweitens: Das „Regulatorik-Vakuum“. Wer die EU-Novel-Food-Verordnungen oder GVO-Richtlinien nicht von Tag eins an in die Produktentwicklung einplant, riskiert Jahre des Stillstands. Drittens: Die Fokussierung auf den Endkonsument*innen statt auf B2B-Integration. Der wahre Hebel liegt in der Lizenzierung von Prozessen an die Industrie. Viertens: Die Unterschätzung der Hardware-Komponente. SynBio ist kein reines Software-Business; ohne Zugang zu physischer Infrastruktur bleibt jede Innovation im Labor gefangen.

Deutschlands Bio-Cluster

Deutschland hat sich im internationalen Vergleich als einer der stärksten Hubs für SynBio etabliert, getrieben durch eine einzigartige Verzahnung von Spitzenforschung und industrieller Basis. In München und dem angeschlossenen IZB Martinsried konzentriert sich die größte Dichte an Venture Capital und Talenten, eng flankiert durch die Exzellenz-Cluster der TU München. Berlin hat sich durch spezialisierte Inkubatoren wie den ProVeg Incubator, Atlantic Food Labs (FoodLabs) und den Science Park Berlin-Buch zum absoluten Zentrum für FoodTech und zelluläre Landwirtschaft entwickelt. Ein weiterer Hotspot ist das Rhein-Neckar-Delta rund um Heidelberg, wo das European Molecular Biology Laboratory (EMBL) und der BioRN-Cluster eine Brücke zwischen Grundlagenforschung und Marktreife schlagen. Aachen punktet mit der RWTH und einer starken Fokussierung auf Bio-Verfahrenstechnik, während der Raum Darmstadt/Frankfurt durch die Nähe zu Giganten wie Merck und die TU Darmstadt als Kraftzentrum für die industrielle Bioproduktion gilt.

Investor*innen-Radar

Die Finanzierungslandschaft hat sich spezialisiert. Wir unterscheiden im Jahr 2026 vier Ebenen der Kapitalgeber*innen. Die spezialisierten VCs wie Forbion, BlueYard Capital oder Sofinnova Partners bringen das notwendige tiefe Domänenwissen mit. Auf der zweiten Ebene stehen Top-Tier Generalisten wie HV Capital und Earlybird, die SynBio zunehmend als Teil ihrer Dekarbonisierungs-Strategie begreifen. Besonders kritisch für die Skalierung sind die Corporate VCs der Industrie, allen voran BASF Venture Capital und Evonik Venture Capital, die nicht nur Geld, sondern auch Abnahmegarantien und technisches Know-how bieten. In der Frühphase bewegen zudem spezialisierte Mikro-Fonds wie Nucleus Capital oder erfahrene ClimateTech-Angels den Markt, oft organisiert in Syndikaten, die das „Valley of Death“ zwischen Labor und Prototyp überbrücken

Die Top-Start-ups: Unsere Must-Watch-Liste 2026

Für die folgende Auswahl der Start-ups haben wir Unternehmen analysiert, die nach 2019 in Deutschland gegründet wurden. Die Auswahlkriterien basieren auf der technologischen Tiefe (IP-Portfolio), dem Reifegrad der Pilotierung, der Validierung durch renommierte Investoren sowie dem Potenzial, bestehende industrielle Lieferketten systemisch zu verändern. Diversität in Gründungsteams und die Skalierbarkeit der zugrunde liegenden Bio-Plattform waren weitere entscheidende Faktoren.

- Cambrium (Berlin, gegründet 2020): Das Team um Dr. Mitchell Duffy nutzt eine KI-gestützte Designplattform, um neuartige Proteine mit molekularen Funktionen zu entwickeln, die in der Natur so nicht vorkommen. Ihr Fokus liegt auf der Kosmetik- und Textilindustrie, wo sie petrochemische Inhaltsstoffe durch bio-designte Alternativen ersetzen. Mit massiven Finanzierungsrunden, angeführt von Tech-Schwergewichten wie Essential Capital und dem Google-KI-Fonds Gradient Ventures, gilt Cambrium als Leuchtturm für eine neue Generation von Biomaterial-Zulieferern, die aus digitalem Code physische Hochleistungsprodukte erschaffen.

- Bluu Seafood (Berlin, gegründet 2020): Gegründet von Dr. Sebastian Rakers und Simon Fabich, ist Bluu einer der führenden europäischen Akteure im Bereich kultivierter Fisch. Durch die Kultivierung echter Fischzellen im Bioreaktor adressieren sie die Überfischung der Meere. Nach signifikanten Investments durch Lead-Investor Sparkfood sowie LBBW VC und Delivery Hero Ventures steht das Unternehmen kurz vor der ersten Marktzulassung in Singapur und den USA.

- Colipi (Hamburg, gegründet 2022): Das Spin-off der TU Hamburg, geführt von Maximilian Webers, nutzt eine patentierte Gasfermentationstechnologie, um CO2 in nachhaltige Öle und Lipide umzuwandeln. Der USP von Colipi ist die Nutzung von industriellen Abgasströmen als Rohstoff, was die Produktion extrem kosteneffizient macht. Sie konnten sich frühzeitig die Unterstützung von Top-Investoren wie dem High-Tech Gründerfonds (HTGF) und dem Innovationsstarter Fonds Hamburg sichern.

- Kynda (Jelmstorf, gegründet 2019): Ursprünglich als Keen 4 Greens von Daniel MacGowan-von Holstein und Franziskus Schnabel gegründet, bietet Kynda Plug-and-Play-Fermentationssysteme für die Lebensmittelindustrie an. Als B2B-Technologiepartner stellen sie modulare Bioreaktoren und Pilzkulturen bereit, mit denen Hersteller ihre eigenen Produktionsabfälle direkt vor Ort kostengünstig in Mykoproteine umwandeln können. Eine kürzliche 3-Millionen-Euro-Seed-Finanzierung – angeführt vom VC EnjoyVenture und massiv flankiert durch ein strategisches Investment des Geflügel-Giganten PHW-Gruppe – unterstreicht das enorme Skalierungspotenzial dieses Kreislauf-Modells.

- Nosh.bio (Berlin, gegründet 2022): Das Team um Tim Fronzek nutzt Pilzbiomasse als funktionalen Inhaltsstoff für die Lebensmittelindustrie, um Clean-Label-Produkte ohne Zusatzstoffe zu ermöglichen. Der technologische Vorsprung von Nosh.bio liegt in der Geschwindigkeit des Fermentationsprozesses. Frühphasen-Finanzierungen durch Earlybird unterstreichen das hohe Vertrauen in das Skalierungspotenzial.

- Ucaneo (Berlin, gegründet 2022): Das Team um Florian Tiller und Carla Glassl beweist, dass Synthetische Biologie auch beim Direct Air Capture (DAC) den Unterschied macht. Statt energieintensiver chemischer Filter nutzt Ucaneo eine biomimetische Technologie: Sie setzen das Enzym Carboanhydrase ein – eines der schnellsten Enzyme der Natur –, um CO2 bei Raumtemperatur direkt aus der Umgebungsluft zu binden. Mit starken Frühphasen-Finanzierungen durch DeepTech-Fonds wie Nucleus Capital und der US-amerikanischen Grantham Foundation baut Ucaneo derzeit in Berlin-Marienfelde ihre erste industrielle Testanlage auf.

- Insempra (München, gegründet 2021): Das Team um Gründer Jens Klein hat sich zum Ziel gesetzt, die massive Abhängigkeit der globalen Lieferketten von der Petrochemie zu beenden. Über ihre B2B-Technologieplattform nutzen sie Präzisionsfermentation, um maßgeschneiderte Inhaltsstoffe für die Kosmetik-, Lebensmittel- und Textilbranche quasi zu programmieren – von bio-basierten Lipiden und Aromen bis hin zu neuartigen Proteinfasern. Eine hochkarätige Finanzierungsrunde, angeführt von europäischen DeepTech-Schwergewichten wie EQT Ventures und BlueYard Capital, unterstreicht den Anspruch von Insempra, ein globaler industrieller Zulieferer der nächsten Generation zu werden.

Ausblick & Fazit: Der globale Wettlauf

Der Blick über den Tellerrand zeigt: Wir stehen in einem globalen Systemwettbewerb. In den USA treibt die per Executive Order erlassene „National Biotechnology and Biomanufacturing Initiative“ Milliardeninvestitionen in die heimische Infrastruktur, flankiert von Pionieren, die dort und in Frankreich (wie Biomemory) bereits an der Verschmelzung von SynBio und DNA-Datenspeicherung arbeiten. In Asien, insbesondere in China und Singapur, werden derweil regulatorische Hürden in Rekordzeit abgebaut, um die Marktführerschaft bei der Biomanufaktur zu übernehmen. Flankiert wird dies von Hubs wie Israel, die mit massivem VC-Kapital den globalen Markt für kultivierte Proteine dominieren wollen.

Das Fazit für das Jahr 2026: Biologie ist die Infrastruktur der Zukunft. Für Gründer*innen bedeutet dies, dass die Zeit der reinen Plattform-Versprechen vorbei ist; gefragt sind konkrete Produkte und belastbare Unit Economics. Für Investor*innen bietet SynBio die seltene Chance, echte „Impact-Rendite“ zu erzielen, indem sie Industrien transformieren, die über Jahrzehnte festgefahren waren. Wer heute den Code der Natur versteht und skalieren kann, wird die Welt von morgen nicht nur verstehen, sondern neu bauen.

ENVIOTECH sichert sich Millionenfinanzierung für intelligente öffentliche Straßenbeleuchtung

Das Frankfurter Start-up ENVIOTECH rund um Adrian Rhaese, Linh Pham, Dustin Arnold und Peter Kletsko hat eine Pre-Seed-Runde in Höhe von einer Million Euro abgeschlossen, um öffentliche Straßenbeleuchtung intelligent nachzurüsten. Doch der Markt für kommunale Infrastruktur ist hart umkämpft und bürokratisch. Kann das junge Team die öffentlichen Verwaltungen überzeugen?

Es ist ein klassisches Gründer*innen-Narrativ: Aus einem persönlichen Schmerzpunkt entsteht eine Geschäftsidee. Im Fall von ENVIOTECH war es ein Fahrradunfall. Der beste Freund von Mitgründer Adrian Rhaese verunglückte, weil in einer deutschen Stadt die Straßenlaternen aufgrund gestiegener Stromkosten abgeschaltet worden waren. Dieser Vorfall weckte bei Rhaese das Unverständnis darüber, dass in einem wirtschaftlich starken Land ausgerechnet an der Sicherheit gespart wird – und legte den Grundstein für das Smart-City-Start-up.

Bye-bye Bankenturm: Der Sprung ins kalte Wasser

Anstatt ihren als sicher geltenden Karriereweg fortzusetzen, verließen Adrian Rhaese und Mitgründerin Linh Pham ihre Positionen als duale Studierende bei der Deutschen Bank. Sie entschieden sich bewusst für das unternehmerische Risiko, um reale Infrastrukturprobleme zu lösen.

Eine erste Bestätigung für diesen Schritt erhielt das junge Team durch die Aufnahme in das EWOR Fellowship. Daniel Dippold, Gründer und CEO von EWOR, bescheinigt dem Team den richtigen Fokus: „Unspektakuläre Infrastruktur gewinnt langfristig fast immer. Straßenbeleuchtung ist nicht glamourös, aber sie ist allgegenwärtig, unverzichtbar und aus keiner Stadt wegzudenken.“

Plug-and-Play am Lichtmast: Das 15-Minuten-Update

Die technische Lösung von ENVIOTECH setzt auf Pragmatismus: Anstatt Laternen kostenintensiv komplett auszutauschen, bietet das Unternehmen ein Retrofit-System an. Das Produkt soll sich laut Unternehmensangaben in unter 15 Minuten in bestehende Leuchten integrieren lassen.

Die nachgerüsteten Laternen kommunizieren als Mesh-Netzwerk miteinander und dimmen das Licht KI-gesteuert und bedarfsgerecht anhand von Bewegungserkennung. Das Startup verspricht dadurch Energieeinsparungen von bis zu 80 Prozent; gleichzeitig soll die öffentliche Sicherheit erhöht werden. Kommunen erhalten so die Möglichkeit, ihre Beleuchtung zentral zu steuern und in Echtzeit zu überwachen.

Um das Konzept in die Fläche zu tragen, konnte ENVIOTECH nun eine Pre-Seed-Finanzierung in Höhe von 1 Million Euro einsammeln. Angeführt wird die Runde passenderweise vom ehemaligen Co-CEO der Deutschen Bank, Jürgen Fitschen. Ergänzt wird das Konsortium durch Ex-MAN-CEO Joachim Drees, Alexander Eyhorn (Gründer von Bidirex) und Danilo Jovicic-Albrecht (Mitgründer des auf Kommunen spezialisierten Startups Vialytics). Mit dem frischen Kapital sollen Pilotprojekte forciert und das Technologieportfolio weiterentwickelt werden.

Der Endgegner heißt B2G-Markt: David gegen die Industrie-Goliaths

So einleuchtend die Technologie klingt, das Geschäftsmodell von ENVIOTECH steht vor gewaltigen Hürden. Der B2G-Markt (Business-to-Government) ist für Start-ups extrem schwierig. Kommunen, die ENVIOTECHs primäre Zielgruppe darstellen, arbeiten mit langen Budgetzyklen und streng regulierten öffentlichen Ausschreibungsverfahren. Bis ein Pilotprojekt zu einem flächendeckenden Rollout führt, vergehen oft Jahre.

Darüber hinaus agiert das Start-up nicht im luftleeren Raum. Der Smart-Lighting-Markt wird von Industriegiganten wie Signify oder Schréder dominiert, die längst eigene IoT-Lichtsteuerungssysteme anbieten. Auch andere Start-ups wie Tvilight oder Icegateway haben das Potenzial vernetzter Straßenbeleuchtung erkannt.

Der entscheidende USP von ENVIOTECH muss daher in der Geschwindigkeit und Einfachheit liegen: Gelingt die versprochene rasante Installation und können Kommunen die Lösung ohne massive Tiefbauarbeiten testen, hat das Start-up einen echten Wettbewerbsvorteil. Besonders klug ist hierbei die Auswahl der Investor*innen: Mit Drees und Jovicic-Albrecht hat das Gründerduo Köpfe an Bord geholt, die wissen, wie man komplexe Produkte an die öffentliche Hand verkauft. Schafft es ENVIOTECH, den extrem zähen Vertriebszyklus öffentlicher Verwaltungen zu knacken, könnte das Unternehmen zu einem hochrentablen Hidden Champion heranwachsen.

Gründer*in der Woche: SIRPLUS – Überlebenskampf im Food-Outlet-Markt

Während der millionenschwere Rivale Motatos aus Deutschland flieht, schreibt ein einstiger Sanierungsfall plötzlich schwarze Zahlen. Wie unser(e) Gründer*in der Woche – das Berliner Social Business SIRPLUS von Raphael Fellmer – vom gehypten Start-up zum krisenerprobten Mittelständler reifte.

Das Berliner Social Business SIRPLUS hat bewegte Jahre hinter sich. Nach einer überstandenen Insolvenz 2024 erfindet sich das ehemalige Vorzeige-Start-up um Gründer Raphael Fellmer aktuell neu – und setzt auf Community statt auf klassisches VC-Kapital. Mitten in diese Konsolidierungsphase platzt im April 2026 der Deutschland-Rückzug des Konkurrenten Motatos. Ein Lehrstück über die harten Grenzen des Skalierens und den schmerzhaften Weg vom gehypten Start-up zum krisenerprobten Mittelständler.

Paradoxon im Food-Markt: Der Sanierungsfall überlebt den Giganten

Es ist eine Nachricht, die in der hiesigen FoodTech-Szene aktuell für ein mittelschweres Beben sorgt: Der schwedische Online-Discounter Motatos zieht sich aus Deutschland zurück. Trotz rund 300.000 aktiven Kund*innen und einem beachtlichen Jahresumsatz von über 35 Millionen Euro zieht das Unternehmen Mitte April 2026 die Reißleine. Das Deutschland-Geschäft blieb hochgradig defizitär. Die Begründung: Man wolle sich auf das profitable Wachstum in den nordischen Heimatmärkten konzentrieren. Dieser Rückzug wirft ein grelles Licht auf die strukturellen Herausforderungen des deutschen Lebensmittelmarkts. Doch während der finanzstarke Konkurrent aus dem Norden kapituliert, hält ausgerechnet das Berliner Unternehmen SIRPLUS die Stellung – ein Turnaround-Case, der erst vor Kurzem selbst am Abgrund stand.

Warum überlebt SIRPLUS dort, wo ein millionenschwerer Riese aufgibt? Gründer Raphael Fellmer macht sich keine Illusionen über das Marktumfeld. „Wir haben in Deutschland wohl einen der härtesten umkämpften Lebensmittelmärkte in der EU“, analysiert er die Lage. Dass nach dem US-Giganten Walmart nun mit Motatos der nächste Konzern den Rückzug antrete, sei bezeichnend. Die eigene Überlebensstrategie liege in den Lehren der bitteren Vergangenheit. „Wir haben bei SIRPLUS 2.0 einen so radikalen Pivot hingelegt, wie ich es nicht für möglich gehalten hätte“, betont der Gründer. Das Erfolgsrezept liege heute nicht mehr in der reinen Größe, sondern in extremer Agilität und einem strikten Fokus auf organisches Wachstum. Die Rechnung scheint aufzugehen: Auch wenn die Berliner rund 20-mal weniger Umsatz machen als der scheidende Konkurrent Motatos, schreiben sie laut Fellmer bereits schwarze Zahlen. Für 2026 kündigt er erstmals seit der Gründung mehr Einnahmen als Ausgaben an.

„Das entlastet mich persönlich sehr, weil ich seit Jahren im Dauerfunding-Modus bin.“

Raphael Fellmer über die ersten schwarzen Zahlen seit der Gründung 2017

„Wir sind nicht per Du“: Wenn Purpose auf Realität prallt

Die Geschichte von SIRPLUS ist untrennbar mit seinem prominenten Gründer verbunden. Der Klimaaktivist erlangte Bekanntheit, weil er aus Protest gegen die Wegwerfgesellschaft fünfeinhalb Jahre lang komplett ohne Geld lebte und sich durch „Containern“ ernährte. Nach dem Aufbau der Foodsharing-Initiative folgte 2017 gemeinsam mit Martin Schott die Gründung von SIRPLUS. Das Kern-Geschäftsmodell: Das Unternehmen rettet bei Produzent*innen und Großhändler*innen überschüssige Ware – etwa wegen nahendem Mindesthaltbarkeitsdatum (MHD), Überproduktionen oder Verpackungsfehlern – und verkauft diese D2C (Direct-to-Consumer) über den eigenen Online-Shop mit Rabatt an Endkund*innen.

Damals griff das Team mit diesem Konzept nach den Sternen des klassischen Start-up-Wachstums. Doch der Spagat zwischen Weltverbesserung und knallhart skalierbarem E-Commerce erwies sich als tückisch. Das zeigte sich eindrücklich im September 2019 bei einem denkwürdigen Auftritt in der TV-Show Die Höhle der Löwen. Fellmer und Schott forderten 700.000 Euro für 6 Prozent der Anteile – was einer überaus ambitionierten Firmenbewertung von fast 11,7 Millionen Euro entsprach.

Die Kombination aus Social-Impact-Rhetorik und massiver kapitalistischer Bewertung sorgte für einen beispiellosen Eklat. Investor Georg Kofler warf dem Duo „moralisierendes Schöngerede“ vor. Als die Gründer sich rechtfertigen wollten und Kofler dabei duzten, unterbrach dieser scharf mit einem Satz, der in die deutsche TV-Geschichte einging: „Wir sind nicht per Du. Unter Multimillionären ist man eine Weile per Sie.“ Das Team verließ das Studio ohne Deal. Die Investoren hatten den wunden Punkt getroffen: Ein gesellschaftliches Problem moralisch aufzuladen, heilt keine schwachen Unit Economics.

Rückblickend gibt sich Fellmer geläutert, verhehlt aber auch seine damalige Verletztheit nicht. Die Einladung zur Show habe man primär angenommen, um Reichweite für das Thema Lebensmittelverschwendung zu generieren. „Dass wir so stark kritisiert und vor allem auch persönlich angegriffen würden, hätte ich mir nicht vorstellen können“, gibt er unumwunden zu. Die völlig überzogene Firmenbewertung rechnet er heute der eigenen Naivität an: „Wir kannten uns nicht aus und waren glücklich darüber – ohne zu verstehen, dass eine zu hohe Bewertung auch hinderlich sein kann.“

Der harte Cut: Vom 90-Köpfe-Team zum Sanierungsfall

Die Kritik der Löwen sollte sich in gewisser Weise als prophetisch erweisen. Das Geschäftsmodell erfordert es, schwere, niedrigpreisige Güter aufwendig zu lagern, zu kommissionieren und per Paketdienst zu verschicken. Die Logistikkosten fraßen die Margen auf. Als Ende 2023 im ohnehin schwierigen Marktumfeld eine rettende Finanzierungsrunde platzte, musste SIRPLUS im Januar 2024 Insolvenz anmelden. Und das, obwohl das Team von ehemals rund 90 auf unter 30 Mitarbeitende Monate vor der Pleite radikal eingedampft wurde. Die verlustreichen stationären „Rettermärkte“ gehörten schon zwei Jahre zuvor der Vergangenheit an. Im Mai 2024 gelang zwar die Rettung durch drei Viertel der Bestandsinvestor*innen, doch der Preis war hoch: Aus dem einstigen Hyper-Wachstums-Narrativ wurde ein harter Überlebenskampf. SIRPLUS wurde zeitweise vom gehypten Start-up zum Sanierungsfall.

„Es war sehr hart, nach sieben Jahren Kampf anzuerkennen, dass wir es einfach nicht geschafft haben, wirtschaftlich zu werden.“

Raphael Fellmer über den Tiefpunkt vor dem Neustart

Der personelle Aderlass ging an die Substanz. Zwischenzeitlich kämpfte der Gründer praktisch allein, mit seinem Bruder als einzigem Mitarbeiter. Dennoch sei sein Wille ungebrochen gewesen. Den operativen Neustart nach der Pleite diktierte der Rotstift: „Leane Struktur ohne Obst und Gemüse, keine bezahlte Werbung, sondern organisches Wachstum, kein Büro, sondern Remote-Only“, summiert Fellmer die harten Schnitte. Statt teurer Bezahldeals stütze man sich heute auf langfristige Partnerschaften.

Der radikale Pivot: Community statt teurer Klicks

Aktuell ist SIRPLUS Teil der neuen YouTube-Show The Green Deal, ein Format, das gezielt die Abkehr vom rein kapitalgetriebenen Skalieren propagiert. Der neue Hebel für SIRPLUS: Reichweite, Community-Building und Creator-Beteiligungen. Die betriebswirtschaftliche Logik dahinter ist zwingend: Wenn hohe Customer Acquisition Costs (CAC) im klassischen Performance-Marketing das ohnehin margenschwache Modell ruinieren, muss die Kundenakquise organisch erfolgen. Durch die enge Bindung an Influencer und eine wertegetriebene Community sollen treue Käufer*innenschichten aufgebaut werden.

Dass dieses Konzept mehr als nur eine Notlösung für fehlendes VC-Geld ist, belegen harte Zahlen. Fellmer beziffert die aktuellen Customer Acquisition Costs stolz auf „unter 5 Euro“. Dieser Wert sei sieben- bis zehnmal besser als noch zu Zeiten von SIRPLUS 1.0. Auf klassische Bezahlkooperationen verzichtet das Start-up mittlerweile völlig; man vergütet rein über Umsatzbeteiligungen oder gespendete Schulmahlzeiten. „Wir suchen weiter nach authentischen Partnerschaften mit Menschen mit Reichweite, die sich für eine Welt einsetzen wollen, in der alle genügend zu essen haben“, skizziert Fellmer sein Anforderungsprofil an Creator. Die Strategie trägt Früchte: Von Q1 2025 auf Q1 2026 verzeichnete das Unternehmen laut Gründer ein Wachstum von 100 Prozent.

Die SIRPLUS-Formel: Drei harte Lektionen für Social Start-ups

Warum widmen wir uns bei StartingUp einem neunjährigen Unternehmen, das streng genommen längst kein Start-up mehr ist? Weil junge Gründer*innen aus exakt dieser Transformation unbezahlbare Lehren für die eigene Frühphase ziehen können:

- Purpose ersetzt keine Unit Economics: Der Fall SIRPLUS demonstriert schonungslos, dass selbst die stärkste gesellschaftliche Mission eine fehlerhafte betriebswirtschaftliche Basis (hohe Logistikkosten bei niedrigen Warenkörben) nicht dauerhaft kompensieren kann. Wer heute ein Social Start-up gründet, muss seine Margen noch rigoroser verteidigen als traditionelle E-Commerce-Modelle.

- Die Grenzen des VC-Modells erkennen: Nicht jedes Geschäftsmodell eignet sich für Venture Capital. Die Entwicklung von SIRPLUS und der aktuelle Motatos-Exit zeigen, dass der Food-Outlet-Markt extrem schwer zu skalieren ist. Junge Start-ups lernen hier, alternative Wachstumswege frühzeitig in Betracht zu ziehen, bevor sie sich in eine gefährliche VC-Abhängigkeit begeben.

- Resilienz als Kernkompetenz: Dass Raphael Fellmer das Tal der Tränen durchschritten hat und sich dem Markt nach einer Insolvenz mit angepasstem Modell neu stellt, ist ein Meisterkurs in Pivotierung und unternehmerischer Widerstandskraft.

Die Konkurrenzsituation hat sich durch den Motatos-Exit nun paradoxerweise entspannt. Ob die Gleichung „Reichweite statt Performance-Marketing“ am Ende aufgeht, wird eine der spannendsten Case Studies der aktuellen Wirtschaftsszene – und ein wertvoller Blueprint für die Start-ups von morgen.

Fellmer selbst zeigt sich für die Zukunft demütig, aber siegessicher. Auf dem Weg zur Profitabilität habe man zwar fast 10 Millionen Euro an Funding benötigt und schmerzhaftes Lehrgeld gezahlt, doch „das Dranbleiben, Neudenken und nicht Aufgeben hat sich gelohnt“. Für 2026 verspricht der Gründer erstmals ein nachhaltig profitables Gesamtjahr. Neben der rein wirtschaftlichen Stabilität hat der passionierte Kämpfer gegen Food Waste inzwischen aber auch einen „ganz profanen“ Meilenstein im Visier: „Für mich persönlich ist dieses Jahr ein echter mehrwöchiger Urlaub nach 14 Jahren des Fast-Durch-Arbeitens ein wichtiges Ziel.“

Wie das TechBio-Start-up mbiomics mit 30 Mio. Euro die Krebstherapie skalierbar machen will

Stuhltransplantationen haben gezeigt, dass das Darmmikrobiom ein mächtiger Hebel gegen Krebs sein kann – doch der Ansatz ist bisher kaum standardisierbar. Das Münchner Unternehmen mbiomics setzt auf künstliche Intelligenz und maßgeschneiderte Bakterien-Cocktails aus dem Labor. Mit dem Abschluss einer 30-Millionen-Euro-Serie-A-Runde rückt die klinische Phase näher. Ein genauer Blick auf das Geschäftsmodell, die Gründer*innen und einen hart umkämpften globalen Markt.

Wer heute von modernster Krebstherapie spricht, kommt am menschlichen Darm nicht mehr vorbei. Die wissenschaftliche Datenlage der letzten Jahre hat sich massiv verdichtet: Ob ein Patient auf revolutionäre Krebs-Immuntherapien (wie Immun-Checkpoint-Inhibitoren) anspricht, hängt maßgeblich von der individuellen Zusammensetzung seines Mikrobioms ab. Das Münchner TechBio-Unternehmen mbiomics hat sich genau dieses Zusammenspiel zur Mission gemacht und gab heute den dritten Abschluss seiner Serie-A-Finanzierungsrunde bekannt. Mit neu eingeworbenen 12 Millionen Euro wächst das Gesamtvolumen der Runde auf beachtliche 30 Millionen Euro.

Das Kapital, das unter anderem von erfahrenen Investoren wie den MIG Fonds und Bayern Kapital stammt, markiert für das 2020 gegründete Unternehmen einen entscheidenden Wendepunkt: den Übergang von der reinen Technologieplattform hin zur klinischen Anwendung am Menschen. Der führende Wirkstoffkandidat „MBX-116“ soll 2027 in einer Phase-1B-Studie an Patienten mit fortgeschrittenem schwarzen Hautkrebs (Melanom) getestet werden. Doch wie belastbar ist dieser Ansatz im Vergleich zum Wettbewerb?

Die Köpfe hinter der Vision

Aus der Taufe gehoben wurde mbiomics im Jahr 2020 von Dr. Laura Figulla, Dr. Johannes B. Wöhrstein und Dr. Markus Rinecker. Während die Mitgründer Figulla und Rinecker das Unternehmen in der frühen Phase prägten, wird die nun anstehende Skalierung und klinische Validierung von einem spezialisierten Leadership-Trio gesteuert:

- Dr. Johannes B. Wöhrstein (CEO & Mitgründer): Als technologischer Kopf und Geschäftsführer verantwortet er die firmeneigene Plattform. Seine Expertise in hochauflösender Analytik ist das Fundament, um komplexe mikrobielle Netzwerke mithilfe von maschinellem Lernen (KI/ML) überhaupt erst zu kartieren.

-

Kristin Torre Vinuesa (CFO): Als Chief Financial Officer verantwortet sie die finanziellen Geschicke des Unternehmens. Ihre Rolle ist entscheidend, um die neu eingeworbenen 30 Millionen Euro strategisch einzusetzen, den naturgemäß hohen Kapitalbedarf der anstehenden klinischen Studien („Cash Burn“) effizient zu steuern und das finanzielle Fundament für zukünftige Runden zu sichern.

- Dr. Christopher Weidenmaier (CSO): Der erfahrene Mikrobiologe (zuvor unter anderem beim US-Konkurrenten Finch Therapeutics) komplettiert das heutige Führungstrio. Als Chief Scientific Officer leitet er die präklinische Forschung und treibt das rationale Design der komplexen Bakterien-Konsortien maßgeblich voran.

Das Problem: Die Unberechenbarkeit der Natur

Um das Geschäftsmodell zu verstehen, muss man den Status quo betrachten. In der Onkologie wird aktuell intensiv mit Stuhltransplantationen (Fecal Microbiota Transplants, FMT) experimentiert. Dabei wird das Mikrobiom von Patient*innen, die hervorragend auf Krebsmedikamente ansprechen, auf „Non-Responder“ übertragen. Die Erfolge sind bemerkenswert, doch das Verfahren hat einen massiven Haken: Stuhl ist ein hochvariables Naturprodukt. Er ist schwer zu standardisieren, birgt Infektionsrisiken und lässt sich nicht als skalierbares Pharma-Produkt im industriellen Maßstab herstellen.

Hier setzt mbiomics mit sogenannten Live Biotherapeutic Products (LBPs) an. Statt auf ungefilterte Spender*innen-Transplantate zu setzen, identifiziert das Team mittels KI genau jene Bakterienstämme, die für den therapeutischen Effekt verantwortlich sind. Diese werden dann im Labor nach pharmazeutischen GMP-Standards gezüchtet und als orale Kapsel verabreicht. Es ist der Versuch, die „Blackbox“ Darm in ein berechenbares, patentierbares Medikament zu verwandeln.

Wo liegen die Risiken?

Für Beobachter*innen der Start-up-Szene bleibt das Vorhaben trotz der Millionen-Finanzierung eine Hochrisiko-Wette. Ein TechBio-Start-up in diesem Stadium hat einen enormen „Cash Burn“. Die 30 Millionen Euro sind ein starkes Fundament, doch die klinische Entwicklung in der Onkologie ist ein Langstreckenlauf, der oft dreistellige Millionenbeträge verschlingt.

Zudem ist das Geschäftsmodell hochgradig binär: Die für 2027 geplante Studie muss erst beweisen, dass die im Labor designten Bakterien-Konsortien im komplexen menschlichen Ökosystem tatsächlich die erhoffte Wirkung zeigen. Ein Scheitern des Leitkandidaten MBX-116 könnte das gesamte Vertrauen in die Plattform erschüttern. Zudem ist die Herstellung lebender Bakterien in absolut reproduzierbarer Qualität eine enorme logistische und biotechnologische Herausforderung, an der bereits andere Pioniere der Branche hängen geblieben sind.

Der Markt: Ein globales Rennen

Mbiomics ist nicht allein auf diesem Feld. Das Unternehmen muss sich gegen hochkapitalisierte internationale Konkurrent*innen behaupten:

- MaaT Pharma (Frankreich): Die Franzosen sind klinisch bereits weiter fortgeschritten und setzen auf „Full-Ecosystem“-Produkte aus gepoolten Spenderproben. Mbiomics muss beweisen, dass ihr synthetischer Präzisions-Ansatz dem natürlichen Mix überlegen ist.

- Vedanta Biosciences (USA): Ein US-Schwergewicht, das ebenfalls definierte Bakterienkonsortien entwickelt und bereits über ein breites Netzwerk an Kooperationen mit der Big-Pharma-Industrie verfügt.

Unsere Einordnung

Für das deutsche Ökosystem ist der Erfolg von mbiomics ein Leuchtturm-Signal. Dass Investoren wie MIG – die bereits bei BioNTech ein frühes Gespür bewiesen – hier massiv nachlegen, unterstreicht die Qualität des Standorts München.

Mbiomics wählt den schwierigen, aber potenziell nachhaltigeren Weg. Statt auf die bloße Kopie der Natur zu setzen, versucht das Team, das Mikrobiom durch Daten beherrschbar zu machen. Gelingt der klinische Wirksamkeitsnachweis ab 2027, könnte das Start-up nicht nur die Onkologie verändern, sondern auch Blaupausen für die Behandlung von Autoimmun- und neurodegenerativen Erkrankungen liefern. Der Weg bis dahin bleibt jedoch teuer und wissenschaftlich riskant.

Boschs 200-Mio.-Euro-Wette: Kann der Industrieriese wirklich Start-up?

Bosch pumpt frische Millionen in seinen hauseigenen Venture Builder. Während andere Konzerne ihre Inkubatoren dichtmachen, will der Stuttgarter Hardware-Gigant externe Gründer*innen anlocken und tiefe Tech-Innovationen ausgründen. Ein vielversprechendes Modell für DeepTech-Start-ups – oder eine strategische Sackgasse?

Bosch Business Innovations, der Corporate Venture Builder der Bosch Gruppe, investiert in den kommenden fünf Jahren rund 200 Millionen Euro in den Aufbau neuer DeepTech-Ventures. Das ehrgeizige Ziel: Bis 2030 sollen 20 neue Start-ups außerhalb des Bosch-Kerngeschäfts aufgebaut und zur Marktreife geführt werden. Doch die Ankündigung fällt in eine Zeit, in der das Modell Corporate Venture Building (CVB) in Europa in einer tiefen Krise steckt. Konzern-Inkubatoren von SAP, Allianz oder ProSiebenSat.1 haben in der Vergangenheit längst die Segel gestrichen. Warum glaubt Bosch, die Ausnahme von der Regel zu sein?

DeepTech trifft auf Konzern-Ressourcen

Im Gegensatz zur reinen Investment-Tochter Bosch Ventures (Robert Bosch Venture Capital), die als klassischer Geldgeberin agiert, will Bosch Business Innovations Unternehmen von Grund auf selbst bauen. Zum Start konzentriert sich die Einheit auf drei hochkomplexe Bereiche: medizinische Fernüberwachung, softwaregesteuerte Fertigung und Carbon Capture.

Der Pitch an die Szene klingt verlockend: Bosch verschafft Gründungsteams einen kuratierten Zugang zu Patenten, Forschung, Testlaboren, Ingenieurwissen und globalen Lieferketten. Im Bereich Carbon Capture will man beispielsweise direkt auf bestehende Patente und technologische Vorarbeiten des Konzerns aufsetzen. Externe Gründerinnen und Gründer sollen dabei frühzeitig Verantwortung übernehmen und die Unternehmen von Anfang an aufbauen. Axel Deniz, Geschäftsführer von Bosch Business Innovations, formuliert es so: Man wolle die Technologie und die industrielle Stärke von Bosch mit der Geschwindigkeit und dem unternehmerischen Denken der Start-up-Welt verbinden.

Gegen den „CVB-Winter“

Dass Bosch genau jetzt diese Summen lockermacht, ist ein starkes Signal gegen den aktuellen „CVB-Winter“. Viele Konzern-Inkubatoren scheitern traditionell an der mangelnden Geduld des Mutterkonzerns, quälend langsamen Freigabeprozessen oder einer zu engen inhaltlichen Fesselung an das Bestandsgeschäft.

Bosch versucht, diese strukturellen Fehler zu umgehen, indem der Fokus explizit auf neuen Märkten jenseits des Kerngeschäfts liegt. Zudem öffnet sich die Einheit gezielt für die Außenwelt: Die Zusammenarbeit mit externen Venture Studios und Investor*innen soll den Zugang zu Ökosystemen verbessern und vor allem zusätzliches Kapital mobilisieren. Die Ventures sollen bis zur Investment Readiness begleitet werden und setzen dabei auf Co-Investments. Dass dieser Spin-off-Ansatz Früchte tragen kann, zeigte unlängst der erfolgreiche Exit des Corporate-Start-ups Bosch Advanced Ceramics, das aus dem Bosch-Inkubator hervorging und zum Jahreswechsel 2025/2026 an den japanischen Anlagenbauer Sintokogio verkauft wurde.

Wo liegt der Haken für Gründer*innen?

Trotz dieser Erfolge hat das Modell Tücken, die man kritisch prüfen muss. Die zentrale Frage für externe Gründer*innen lautet: Wie unabhängig kann ein Start-up wirklich agieren, wenn der entscheidende IP-Zugang (Patente, Technologie) vom Mutterkonzern kontrolliert wird?

- Geschwindigkeit vs. Konzernstruktur: Start-ups brauchen Agilität und Pivot-Bereitschaft. Konzerne hingegen neigen dazu, sich durch Vetorechte oder strategische Kontrollmechanismen abzusichern. Es besteht immer die Gefahr, dass der Corporate-Partner eher als Bremse denn als Beschleuniger wirkt.

- Die Cap-Table-Falle: Wenn Bosch das Initialkapital stellt, die Patente einbringt und die Infrastruktur liefert, bleibt für externe Gründungsteams oft nur ein Bruchteil der Anteile. Eine „schiefe“ Cap Table (Kapitalverteilung) kann jedoch spätere VC-Runden massiv erschweren, da externe Investor*innen motivierte Gründer*innen mit signifikanten Anteilen sehen wollen.

- IP-Rechte: Wem gehört die Technologie, wenn das Start-up scheitert oder sich vom Konzern lösen will? Ohne saubere und gründungsfreundliche IP-Transfer-Bedingungen wird jedes Venture zum Gefangenen seines Inkubators.

Unser Fazit: Ein Deal für Heavy-Tech, nicht für Software-Shootingstars

Für Gründer*innen im B2C- oder reinen Software-SaaS-Bereich ist das Angebot von Bosch Business Innovations uninteressant; hier genügen klassische VCs und die eigene Agilität. Wer jedoch im DeepTech-Sektor gründen will – sei es in der industriellen Dekarbonisierung oder der Medizintechnik –, steht oft vor einem enormen Hardware- und Kapital-Bottleneck. Die Entwicklungskosten sind hier astronomisch hoch.

In genau diesen „Hard Tech2-Feldern kann das Angebot von Bosch ein echter Katalysator sein. Der Zugang zu einer der weltweit größten Patentbibliotheken und industrieller Skalierung senkt das Technologierisiko enorm.

Das 200-Millionen-Euro-Commitment ist ein wichtiges Bekenntnis zum DeepTech-Standort Deutschland. Wer als Gründungsteam einsteigt, sollte sich jedoch nicht von den großen Ressourcen blenden lassen, sondern vorab knallhart über Anteile, operative Eigenständigkeit und IP-Rechte verhandeln. Nur wenn Bosch den Gründer*innen echte Beinfreiheit lässt, entstehen hier bis 2030 tatsächlich 20 flugfähige Start-ups – und nicht nur teure, konzerninterne Forschungsprojekte.

Nicht nur pitchen, auch ankommen: Was ein professioneller Auftritt auf Events und Messen ausmacht

Auf Messen zählt für Start-ups mehr als nur der Pitch. Ein souveräner Auftritt gelingt erst durch Struktur, Vorbereitung und das richtige Umfeld.

Wer als junges Unternehmen auf Events, Messen oder Branchentreffen unterwegs ist, denkt oft zuerst an den eigentlichen Auftritt. Pitch, Präsentation, Gespräche am Stand, Networking oder ein Termin mit potenziellen Partnern stehen schnell im Mittelpunkt. Im Alltag zeigt sich aber, dass der professionelle Eindruck viel früher beginnt. Er entsteht nicht erst in dem Moment, in dem gesprochen wird, sondern schon in der Art, wie gut ein Termin vorbereitet ist, wie ruhig ein Tag abläuft und wie stimmig einzelne Programmpunkte ineinandergreifen.

Gerade Start-ups unterschätzen diesen Punkt leicht. In frühen Phasen wird vieles parallel organisiert. Produkt, Kommunikation, Kundentermine und operative Aufgaben laufen ohnehin gleichzeitig. Wenn dann noch ein Event oder eine Messe dazukommt, wird häufig vor allem auf Inhalte geachtet. Das greift aber zu kurz. Denn ein überzeugender Auftritt hängt nicht nur davon ab, was gesagt wird, sondern auch davon, unter welchen Bedingungen dieser Auftritt stattfindet.

Ein guter Eventtag beginnt nicht erst vor Publikum

Viele Termine außer Haus wirken von außen kompakt, sind intern aber erstaunlich dicht. Anreise, Check-in, Abstimmung im Team, Material, Gespräche vor Ort, spontane Kontakte, kurze Pausen und Nachbereitung greifen oft ineinander. Wenn diese Übergänge nicht sauber geplant sind, entsteht unnötige Reibung. Dann fehlt Konzentration genau in den Momenten, in denen ein Unternehmen besonders präsent wirken sollte.

Für Gründerteams ist das relevant, weil auf Messen und Events oft mehrere Ziele gleichzeitig verfolgt werden. Sichtbarkeit, Kundengewinnung, Netzwerke, Partnergespräche und Marktbeobachtung laufen parallel. Wer in diesem Umfeld professionell wirken will, braucht nicht nur gute Inhalte, sondern auch einen Ablauf, der Stabilität gibt.

Warum der Gesamteindruck mehr ist als Pitch und Outfit

Ein professioneller Auftritt wird oft zu eng verstanden. Viele denken dabei an Kleidung, Präsentationsmaterial oder das Gespräch selbst. Tatsächlich wirkt aber der gesamte Rahmen mit. Wer gehetzt ankommt, Unterlagen spontan zusammensucht oder zwischen Programmpunkten keine klare Struktur hat, verliert schnell Wirkung. Umgekehrt kann ein klar organisierter Tag dafür sorgen, dass auch kurze Kontakte souveräner und verbindlicher erscheinen.

Das ist gerade für Start-ups wichtig, weil sie häufig nicht mit Größe, sondern mit Klarheit, Präsenz und Verlässlichkeit punkten müssen. Auf Events zählt nicht nur der Inhalt, sondern auch das Gefühl, das ein Gespräch hinterlässt. Wirkt ein Team vorbereitet? Ist es ansprechbar, ohne hektisch zu sein? Kann es zwischen verschiedenen Terminen professionell umschalten? Solche Faktoren entscheiden mit darüber, wie ein junges Unternehmen wahrgenommen wird.

Mehrtägige Formate brauchen einen besseren Rahmen

Besonders deutlich wird das bei Messen oder Veranstaltungen, die nicht nach zwei Stunden vorbei sind. Wer über mehrere Programmpunkte, Tage oder Abendtermine hinweg präsent sein muss, braucht mehr als nur eine Anreiseoption. Dann geht es darum, wie sich ein Ablauf tragen lässt, ohne dass die Qualität des Auftritts im Laufe des Tages spürbar sinkt.

Wenn rund um Messen, Pitches oder Vor-Ort-Termine mehrere Programmpunkte zusammenkommen, kann ein modernes Hotel Nürnberg den professionellen Rahmen eines solchen Auftritts sinnvoll ergänzen. Der Mehrwert liegt dabei nicht in Übertreibung, sondern in Nutzbarkeit. Wer zwischen Terminen kurz zurückkehren, sich sortieren, Material anpassen oder den nächsten Programmpunkt vorbereiten kann, arbeitet meist klarer. Gerade bei jungen Unternehmen, in denen oft wenige Personen viele Rollen gleichzeitig übernehmen, ist das ein echter Vorteil.

Vorbereitung endet nicht mit der Anreise

Viele Eventtage scheitern nicht an mangelnder Motivation, sondern an zu wenig Struktur. Deshalb lohnt es sich, vorab einfache Fragen sauber zu klären. Welche Termine sind wirklich entscheidend? Wo braucht es bewusst freie Zeitfenster? Wer übernimmt welche Gespräche? Welche Unterlagen müssen jederzeit griffbereit sein?

Solche Punkte wirken unscheinbar, haben aber direkten Einfluss auf die Außenwirkung. Wer vorbereitet wirkt, schafft schneller Vertrauen. Wer im Ablauf ruhig bleibt, kann auch im Gespräch überzeugender auftreten. Gerade auf Messen, wo viele Eindrücke gleichzeitig auf Besucher und Aussteller einwirken, macht diese Form von Klarheit einen spürbaren Unterschied.

Auch das Umfeld beeinflusst den Auftritt

Ein weiterer Punkt wird oft übersehen: Der Ort rund um einen Termin beeinflusst mit, wie konzentriert und professionell ein Tag abläuft. Das gilt nicht nur für die Messehalle oder den Veranstaltungsraum selbst, sondern auch für alles davor und danach. Wo wird vorbereitet? Wo wird nach einem Gespräch noch kurz sortiert? Wo kann ein Team den Tag sinnvoll strukturieren?

Auch ein stilvolles Hotel Düsseldorf wird dort interessant, wo Geschäftstermine, Veranstaltungen und Vorbereitung nicht isoliert, sondern als zusammenhängender Arbeitsablauf gedacht werden.

Gerade in solchen Zusammenhängen zeigt sich, dass professionelle Präsenz mehr ist als reine Sichtbarkeit. Sie entsteht dort, wo Inhalt, Ablauf und Umfeld zusammenpassen. Hotels wie das Cloud One passen deshalb gut in dieses Bild, wenn junge Unternehmen einen Messe- oder Eventtag nicht nur absolvieren, sondern strukturiert und professionell aufsetzen wollen.

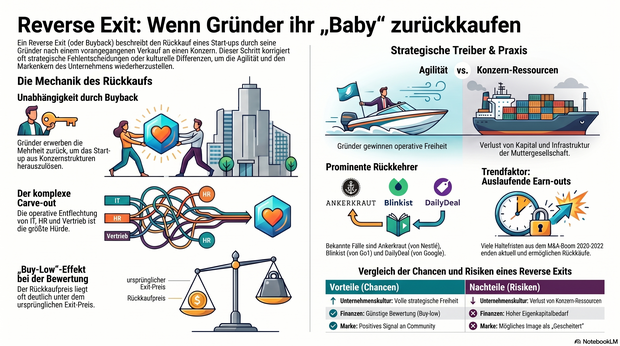

Reverse Exit: Wenn der Exit den Rückwärtsgang einlegt

In jüngster Zeit häufen sich in der Start-up-Szene Fälle, in denen Gründer*innen ihr Lebenswerk nach einem Exit überraschend zurückkaufen. Wir zeigen, was es mit dem Reverse Exit auf sich hat.

Für die meisten Gründer*innen ist er das ultimative Ziel auf der Start-up-Reise: der Exit. Doch was passiert, wenn die Traumhochzeit mit dem Konzern oder dem/der Großinvestor*in im Alltagstresor der Konzernstrukturen erstickt? Der sogenannte Reverse Exit rückt in den Fokus – und wirft für angehende wie gestandene Gründer*innen die Frage auf, ob ein Verkauf wirklich immer das Ende der eigenen Unternehmensgeschichte sein muss.

Was ist ein Reverse Exit?

Ein Reverse Exit (oft auch als Buyback oder Management Buyout / MBO nach einem vorherigen Verkauf bezeichnet) beschreibt den Vorgang, bei dem die ursprünglichen Gründer*innen oder das Managementteam die Mehrheit oder alle Anteile ihres Start-ups von dem/der bisherigen Käufer*in zurückerwerben. Das Start-up wird dadurch aus den Strukturen des Konzerns oder der Investor*innengruppe herausgelöst und agiert wieder als eigenständiges, unabhängiges Unternehmen.

Motivation der Beteiligten: Warum die Rolle rückwärts?

Ein Reverse Exit geschieht selten aus einer Laune heraus. Er ist zumeist das Ergebnis eines Reifeprozesses, bei dem beide Seiten erkennen, dass getrennte Wege wirtschaftlich und strategisch sinnvoller sind.

- Motivation der Gründer*innen (Käufer*innen): Oft prallen nach einem Exit die agile Start-up-Kultur und starre Konzernprozesse schmerzhaft aufeinander. Gründer*innen wollen die operative Entscheidungsgewalt zurückerlangen, eine verwässerte Markenidentität retten oder das Unternehmen schnell auf neue Markttrends (wie aktuell künstliche Intelligenz) ausrichten, was im Konzerngeflecht schlicht zu lange dauern würde.

- Motivation der Corporates (Verkäufer*innen): Konzerne trennen sich meist wieder von ihren Zukäufen, wenn das Start-up die erhofften Synergien nicht bringt oder die Umsätze nach der Übernahme stagnieren. Manchmal ändern sich auch die strategischen Kernziele des Mutterkonzerns, sodass das Start-up als „Non-Core-Asset“ wieder abgestoßen wird.

Vor- und Nachteile eines Reverse Exits

Der Rückkauf des eigenen „Babys“ mag romantisch klingen, ist wirtschaftlich aber ein enormer Kraftakt. Die wichtigsten Aspekte im Überblick:

Aspekt | Vorteile (Chancen) | Nachteile (Risiken) |

Unternehmenskultur | Volle strategische Freiheit und Rückbesinnung auf den ursprünglichen Markenkern | Verlust der Konzern-Ressourcen (Kapital, Vertriebsnetzwerk, Infrastruktur) |

Finanzen | Chance auf eine günstige Unternehmensbewertung beim Rückkauf (Buy-low-Effekt) | Hoher Kapitalbedarf für den Erwerb und das anschließende operative Geschäft |

Image & Marke | Starkes, positives Signal an die Community und Mitarbeiter („Wir sind wieder da“) | Reputationsrisiko bei künftigen B2B-Partner*innen, möglicher „Gescheitert“-Stempel |

Neben diesen offensichtlichen Punkten gibt es weitere, tieferliegende Schmerzpunkte, die bei einem Buyback zwingend auf dem Schirm sein müssen:

- B2B-Kund*innen und „Change of Control“-Klauseln: Große Enterprise-Kund*innen arbeiten oft gern mit Start-ups zusammen, weil im Hintergrund ein bonitätsstarker Konzern steht. Fällt dieses Sicherheitsnetz weg, greifen in Verträgen oft sogenannte Change of Control-Klauseln. Diese räumen den Kun*innen ein Sonderkündigungsrecht ein, weshalb wichtige Großkund*innen oft mühsam neu verhandelt werden müssen.