Aktuelle Events

Die Leistung ganz einfach überwachen

Mit der für sie passenden Software-Lösung haben Gründer die permanente Kontrolle über ihre IT-Strukturen und können sich umso intensiver dem Auf- und Ausbau ihres Unternehmens widmen.

Sind Sie sich sicher, dass überall im System alles wie gewünscht verläuft? Die Leistung von Software- und Hardwarekomponenten in einem System sollte laufend überwacht werden. Ein plötzlicher Leistungsabfall kann sich nämlich auf das ganze System auswirken, gerade wenn er an einem wichtigen Ort vorkommt. In einem Zeitalter, in dem geschäftlich so gut wie alles von einem perfekt arbeitenden Computersystem abhängt, ist die Zuverlässigkeit dieses Systems eine Grundvoraussetzung für eine gut funktionierende Geschäftstätigkeit. Ein Engpass hat Auswirkungen auf die Effizienz Ihrer Mitarbeiter und letztlich auch auf die Dienstleistungen, die Sie Ihren Kunden anbieten möchten.

Engpässe früh erkennen – und verhindern

Man stelle sich vor, Sie lancieren über Ihre Webseite ein neues Produkt. Doch die Webseite ist nur in der Lage, einen Bruchteil der Anfragen zu verarbeiten, bevor sie überlastet ist. Dies legt die Webseite lahm – nicht nur für die Interessenten an Ihrem neuen Produkt, sondern auch für alle anderen Kunden, die vielleicht aus anderen Gründen auf diese Webseite zugreifen wollten. Hätten Sie sich jedoch rechtzeitig über die Serverkapazitäten informiert gehabt, wäre es vielleicht auch noch möglich gewesen, die nötige Kapazität bereitzustellen, um dem Ansturm gewachsen zu sein.

Doch wie erkennt man Schwachstellen in einem System, das aus vielen größeren und kleineren einzelnen Komponenten besteht? Grundsätzlich deckt der Microsoft System Center Operations Manager (SCOM) alle Belange im Zusammenhang mit Produkten von Microsoft ab. Es überwacht die Leistung aller im System vorhandenen und aktiven Komponenten und setzt Warnungen ab, sobald irgendwo Engpässe entstehen oder es sogar einen Schaden zu beheben gibt. Es sammelt die Protokolldateien der verschiedenen Applikationen und wertet diese zuhanden des Administrators aus, sodass dieser einfacher seine Entscheidungen treffen kann.

Je mehr Komponenten in einem System vorhanden sind, desto größer ist auch die Wahrscheinlichkeit, dass es sich um Komponenten verschiedener Hersteller handelt. Nicht immer lassen sich diese auch mit dem standardmäßigen SCOM von Microsoft überwachen. Mit einer SCOM-Überwachungslösung von SolarWinds hingegen sind Sie bestens ausgerüstet, um auch in einem vielseitig ausgestatteten Netzwerk Leistung und Zuverlässigkeit garantieren zu können. Diese Lösung sorgt dafür, dass Sie nicht mit mehreren Trialware-Packs arbeiten müssen, um Ihr System überwachen zu können.

Gute Planung als Schlüssel zum Erfolg

Wann ein Server wie stark beansprucht wird, ist unter Umständen nicht sehr einfach abzuschätzen. Dazu braucht es Erfahrungswerte, doch auch diese können die Zukunft nicht vollständig vorhersagen. Entsprechend ist es wichtig, dass die Systemüberwachung möglichst präzise arbeitet, unabhängig davon, wie homogen oder heterogen ein System aufgebaut ist. Heterogen kann in diesem Zusammenhang bedeuten, dass beispielsweise Hardware- oder Softwarekomponenten von komplett verschiedenen Herstellern im Einsatz sind.

Gerade als Jungunternehmer haben Sie vielleicht noch viele andere Dinge im Kopf, als das Sie sich ausführlich solchen Details in der IT widmen könnten. Gleichzeitig haben Sie mit einem Start-up auch bestimmt nicht die Ressourcen, die es braucht, um all diese Belange unter dem eigenen Dach abzudecken. Mit der richtigen Trialware-Lösung haben Sie allerdings das Nötigste getan, um dafür zu sorgen, dass der Betrieb auch dann noch sauber läuft, wenn Sie hoffentlich vom eigenen Erfolg überrannt werden. Es gilt stets auf der Hut zu sein – die richtige Trialware hilft Ihnen dabei.

Diese Artikel könnten Sie auch interessieren:

Produktivität statt Überstunden: Wie Echtzeitdaten das Finanzwesen von morgen steuern

Das KI-gestützte Fintech Embat beendet das Excel-Chaos im Treasury und macht Finanzteams mit Echtzeitdaten fit für die Zukunft.

Berlin, 28. April 2026 – Es ist ein bekanntes Bild in den Finanz- und Treasury-Abteilungen des deutschen Mittelstands: Wenn der Monatsabschluss naht oder Ad-hoc-Berichte für die Geschäftsführung benötigt werden, bleiben die Schreibtischlampen bis spät in die Nacht an. Die manuelle Zusammenführung von Daten aus unterschiedlichen Bankportalen und historisch gewachsenen Excel-Listen kostet nicht nur Nerven, sondern vor allem wertvolle Zeit.

Das schnell wachsende Fintech Embat tritt an, um genau diesen Engpass aufzulösen. André Reimers, Head of DACH, treibt diese Mission im deutschsprachigen Raum als Gesicht des Unternehmens voran. Seine Kernüberzeugung: Wer heute noch regelmäßig Überstunden machen muss, um finanzielle Transparenz zu schaffen, leidet nicht unter mangelnder Einsatzbereitschaft – er leidet unter einem strukturellen Datenproblem.

Beeindruckendes Wachstum durch das Lösen echter Pain Points

Dass der Schmerz in den Finanzabteilungen groß und der Bedarf an modernen Lösungen riesig ist, belegen die Zahlen, mit denen Embat den europäischen Markt aufrollt. Mit einem starken Kundenwachstum im deutschen Markt von über 250 Prozent im vergangenen Jahr und mittlerweile mehr als 400 mittelständischen und großen Unternehmenskunden weltweit hat sich das Fintech als fester Player etabliert. Das stetig wachsende Transaktionsvolumen von 250 Millionen Euro zeigt deutlich: Der Wechsel von fehleranfälligen Tabellen zu automatisierten Cloud-Lösungen ist in vollem Gange.

Der Weg aus der Excel-Falle

Mit seiner Technologie nimmt Embat den Kampf gegen ineffiziente Prozesse im Treasury auf. Anstatt hochqualifizierte Mitarbeiter mit repetitiver Datenpflege zu binden, automatisiert das System die Konsolidierung aller relevanten Finanzdaten.

„Die Erwartungshaltung, dass komplexe Finanzanalysen zwingend mit langen Abenden im Büro einhergehen müssen, ist schlichtweg nicht mehr zeitgemäß“, erklärt André Reimers. „Wenn Cashflow, Liquidität und Runways per Knopfdruck in Echtzeit abrufbar sind, ändert sich die gesamte Arbeitsdynamik. Finanzteams können aus dem reaktiven Modus heraustreten und sich auf die strategische Steuerung des Unternehmens konzentrieren.“

Hohe Innovationskraft trifft auf lokales DACH-Verständnis

Embat profitiert von einer enormen Innovationsgeschwindigkeit und Agilität, auf der die starke technologische Basis des Unternehmens beruht. Wie diese passgenau auf die spezifischen Bedürfnisse des deutschen Marktes übersetzt wird und für eine hohe lokale Marktpräsenz sorgt, zeigt André Reimers an den Standorten in München und Berlin.

Von diesen beiden Standorten aus steuert André Reimers das DACH-Geschäft und stellt das tiefe Verständnis für die komplexen Strukturen und hohen Sicherheitsbedürfnisse des deutschen Mittelstands sicher. Das Team zeigt dabei, wie moderne, dezentrale Zusammenarbeit erfolgreich funktioniert. Das Vertrauen der stetig wachsenden deutschen Kundenbasis fußt dabei auf dieser geballten lokalen Expertise gepaart mit der unerschütterlichen Zuverlässigkeit der Systeme.

Führen durch Resultate, nicht durch Anwesenheit

Die Botschaft an die Finanzwelt ist klar: Moderne Führung, hohe Produktivität und Skalierbarkeit erfordern keine starren Kontrollmechanismen oder endlosen Arbeitstage. Sie erfordern radikale Datentransparenz und die richtigen digitalen Werkzeuge. Wenn die Daten in Echtzeit fließen, sinkt die Fehlerquote, die Entscheidungsgeschwindigkeit steigt – und die systembedingten Überstunden im Treasury gehören endgültig der Vergangenheit an.

Über Embat:

Embat ist ein KI-gestütztes FinTech mit Schwerpunkt auf Treasury-Management, das es mittelständischen Unternehmen und Großkonzernen ermöglicht, ihre Finanzprozesse in Echtzeit zu zentralisieren. Gegründet von Antonio Berga und Carlos Serrano – ehemaligen J.P. Morgan-Managern mit umfassender Erfahrung im Corporate Banking – sowie Tomás Gil, dem ehemaligen CTO von Fintonic, entstand die Plattform mit der Mission, die Finanzabteilung zu digitalisieren. Die klare Prämisse dabei: Technologie von Finanzexperten für Finanzexperten.

Durch seine hybride Konnektivität lässt sich Embat in über 15.000 Banken und führende ERP-Systeme integrieren und beseitigt so jegliche Datenfragmentierung. Das wichtigste Alleinstellungsmerkmal ist TellMe, ein „Agentic Treasury Analyst“ (autonomer KI-Analyst), der Cashflow-Muster erkennt, komplexe Kontenabstimmungen automatisiert und strategische Entscheidungen zur Optimierung der Liquidität vorschlägt.

Mit Niederlassungen in Madrid, London, Berlin und München definiert Embat die Zukunft des Corporate Finance neu.

Stallgrün: Mit Hightech-Kräutern gegen den Agrar-Strukturwandel

Leere Ställe als Chance: das 2023 von Judith Ryll und Thorsten Lansmann-Niehaus gegründete Stallgrün nutzt Bestandsbau für Indoor Farming. Wir checken das Modell hinter der aktuellen 125.000-€-DBU-Förderung.

Der Strukturwandel in der deutschen Landwirtschaft ist unaufhaltsam: Allein zwischen 2013 und 2023 ging die Zahl der hiesigen Betriebe mit Schweinehaltung um 44 Prozent zurück, wie Zahlen des Bundesministeriums für Ernährung und Landwirtschaft (BMEL) belegen. Jedes Jahr geben Landwirt*innen auf. Zurück bleiben leere Ställe – und Landwirtschaftsbetriebe auf der Suche nach neuen finanziellen Perspektiven.

Das 2023 in Münster gegründete Start-up Stallgrün will aus diesen „Stranded Assets“ einen lukrativen Zukunftsmarkt formen: Indoor Farming im ehemaligen Schweinestall. Die Deutsche Bundesstiftung Umwelt (DBU) unterstützt das Projekt aktuell mit 125.000 Euro im Rahmen ihrer Green Startup-Förderung. Wir wollten wissen: Wie tragfähig ist das Modell jenseits der Fördergelder wirklich?

Die Köpfe hinter der Idee & die Historie

Hinter Stallgrün stehen die Gründer Judith Ryll und Thorsten Lansmann-Niehaus. Ryll bringt als Biowissenschaftlerin tiefe Expertise in der Pflanzenbiologie mit, während Lansmann-Niehaus – der bezeichnenderweise selbst auf einem Schweinemastbetrieb aufwuchs – die kaufmännische Führung übernimmt. Gefördert durch regionale Inkubatoren wie das Seedhouse, hat das Duo den technologischen Machbarkeitsnachweis bereits erbracht: In den vergangenen zwei Jahren wurde das Konzept auf einer Pilotfarm erfolgreich entwickelt.

Das Geschäftsmodell: Mehr als nur Hardware

Die Grundprämisse ist so simpel wie pragmatisch: Ehemalige Schweineställe sind in der Regel massiv gebaut sowie gut isoliert und bieten damit architektonisch ideale Bedingungen für den ganzjährigen Anbau von regionalen Kräutern und Gemüse. Stallgrün positioniert sich als B2B-Technologie- und Service-Provider für Höfe im Wandel und will deutschlandweit agieren. Das System fußt auf drei wesentlichen Säulen:

- Automatisierte Anlagentechnik: Als Kernprodukt hat das Start-up während der DBU-Förderung eine Anlage entwickelt, welche die Bewässerung, Düngung, Belichtung und Klimatisierung automatisiert steuert.

- Datengetriebene Agrar-Software: Ergänzend liefert das Team spezifische Anbauprotokolle für die teilnehmenden Betriebe. Für geeignete Kulturen wurde der optimale Einsatz von Parametern wie Saatgut, Erde, Dünger, Licht und Bewässerungszyklen definiert.

- B2B-Ökosystem: Um die Einstiegshürde zu minimieren, hat Stallgrün einen Materialhandel für passendes Anbaumaterial aus einer Hand aufgebaut und bietet rechtliche Hilfen bei der Verwaltung an. Zudem unterstützt das Start-up beim Aufbau der Vermarktung.

Stallgrün versteht sich dabei nicht als Feind der traditionellen Landwirtschaft. Laut Lansmann-Niehaus ist Indoor Farming kein Ersatz für den etablierten Freiland- oder Gewächshausanbau, sondern eine wetter- und klimaunabhängige Ergänzung.

Die Vision: Produkte sollen ganzjährig regional verfügbar gemacht werden. Die vermehrte Nutzung regionaler Lebensmittel anstelle von Importen reduziere zudem den Transportaufwand und die daraus entstehenden Emissionen.

Kritische Markteinordnung

Der Markt für Vertical- und Indoor-Farming ist ein hartes Pflaster. Prominente Branchenvorreiter wie das ehemals hochgelobte Berliner Start-up Infarm haben in der Vergangenheit massiv Risikokapital verbrannt, weil die schiere Skalierung von energieintensiven Hightech-Farmen in urbanen Ballungsräumen betriebswirtschaftlich oft zum Scheitern verurteilt war.

Hier liegt der geniale, aber auch kritische Hebel von Stallgrün: Anstatt teure Gewerbeimmobilien anzumieten, nutzt das Team bestehende, ländliche Infrastruktur. Das verhindert eine zusätzliche Versiegelung von Flächen, was auch DBU-Generalsekretär Alexander Bonde als zentralen ökologischen Faktor hervorhebt. Ein weiterer Wettbewerbsvorteil: Viele Höfe verfügen bereits über großflächige Photovoltaikanlagen auf ihren Stalldächern. Damit lässt sich der enorme Strombedarf für die Belichtung und Klimatisierung teilweise direkt durch eigenen, günstigen Sonnenstrom abdecken.

Dennoch bleiben aus unserer Sicht drei gravierende Hürden für das Geschäftsmodell:

- CAPEX-Intensität: Die Umrüstung eines leeren Stalls in eine funktionsfähige Hightech-Anlage ist extrem kapitalintensiv. Es bleibt fraglich, wie Landwirte, die gerade aus der unprofitablen Schweinehaltung ausgestiegen sind, das nötige Investitionskapital für diesen Hardware-Neustart bei ihren Banken abrufen können.

- Radikaler Kulturwandel: Einen traditionellen Schweinemäster in einen agilen, datengetriebenen Indoor-Kräuterproduzenten zu transformieren, erfordert enormen Beratungs- und Change-Management-Aufwand seitens Stallgrün.

- Wettbewerb & Margendruck: Die teilnehmenden Bauern und Bäuerinnen kämpfen letztlich gegen die extrem knappen Margen des Lebensmitteleinzelhandels.

Unser Fazit

Stallgrün liefert einen erfrischend bodenständigen „Hardware-meets-Agrar“-Ansatz in einem Tech-Segment, das lange Zeit von utopischen, rein urbanen Vertical-Farming-Träumereien dominiert wurde. Durch die kluge Umnutzung von Infrastruktur-Altlasten und die clevere Kombination aus Hardware, Software-Protokollen und einem integrierten B2B-Serviceangebot hat das Duo ein System aufgebaut, das ein hohes Skalierungspotenzial besitzt.

Die DBU-Förderung von 125.000 Euro ist ein sauberes Validierungssignal für den positiven ökologischen Impact der Gründer*innen. Die wahre Reifeprüfung wird nun jedoch in den Bilanzen der kooperierenden Landwirte stattfinden: Nur wenn die Höfe durch den automatisierten Anbau zügig ihre hohen Anfangsinvestitionen amortisieren können, wird aus dem Münsteraner Pilotprojekt ein neuer bundesweiter Agrar-Standard. Ein mutiger Pivot für die heimische Landwirtschaft – und ein Start-up, das man als Investor*in und Beobachter*in der Agrar-Wende unbedingt auf dem Zettel haben sollte.

5 Mio. Euro für die „Schreibtischlosen“: Kann Elephant den Frontline-Markt wirklich digitalisieren?

Operative Teams in der Produktion, der Logistik oder im Service gelten bei der Digitalisierung oft als vernachlässigt. Das Berliner Start-up Elephant verspricht Abhilfe durch KI-gestütztes Micro-Learning und sicherte sich dafür nun 5 Millionen Euro. Doch zwischen dem PR-Versprechen und der harten Shopfloor-Realität warten ein eng besetzter Markt und die Gefahr der technologischen Austauschbarkeit.

Die aktuelle Finanzierungsrunde wird von den Corporate-Venture-Capital-Einheiten (CVC) EnBW New Ventures und Wepa angeführt. Dass ausgerechnet diese Player investieren, ist kein Zufall: Die Mutterkonzerne steuern selbst riesige operative Belegschaften. Sie dienen der Elephant Technologies GmbH somit nicht nur als Geldgeber, sondern gleichzeitig als Testlabor und Referenzkund*innen. Ergänzt wird die Runde durch namhafte Angel-Investoren aus dem Umfeld von Flix und Home24.

Das Geschäftsmodell: KI-Kurse gegen das „Wissens-Leck“

Die Gründer Maurice Zomorrodi, Niklas Dehio und Melchior Schramm riefen Elephant im Sommer 2022 ins Leben. Sie adressieren ein strukturelles Problem: Wissen wird in operativen Betrieben oft noch mündlich oder über veraltete Handbücher weitergegeben. Die Elephant-Plattform nutzt einen KI-gestützten „Coursebuilder“, um aus bestehenden Dokumenten mit wenigen Klicks interaktive Lerneinheiten für eine mobile App zu generieren. Ein KI-Assistent soll Fragen zudem kontextbezogen direkt am Arbeitsplatz beantworten. Um Sprachbarrieren in der Industrie abzubauen, bietet das System Übersetzungen in über 95 Sprachen. Dass das Modell Anklang findet, zeigt sich am Solar-Einhorn Enpal, das Elephant zur Schulung von Quereinsteigern nutzt.

Journalistisch betrachtet muss man jedoch das Preisschild hinterfragen: Der Einstieg in die Plattform beginnt bei 640 Euro monatlich für bis zu 50 Nutzer*innen („Team“) und skaliert über 1.300 Euro („Pro“) bis hin zu Enterprise-Lösungen ab 4.000 Euro im Monat. Für Mittelständler*innen ist das ein beachtlicher Kostenblock, der sich zügig durch messbar sinkende Fehlerquoten oder kürzere Onboarding-Zeiten rechtfertigen muss.

Ein Markt im Goldrausch: Wer sind die Jäger*innen?

Elephant ist längst nicht allein auf der Jagd nach der „Deskless Workforce“. Dieses enorme Segment hat in den letzten Jahren mächtige Wettbewerber auf den Plan gerufen. So hat beispielsweise der Branchen-Riese Beekeeper die Frontline-Trainingsplattform eduMe nahtlos in seine App integriert, um Mitarbeitenden Weiterbildung mit nur einem Klick zugänglich zu machen. Solche Konsolidierungen zeigen: Der Standard im operativen Weiterbildungsmarkt wird zunehmend höher.

Zwischen Innovation und Commodity

Trotz des Kapitalschubs steht das Start-up vor zwei entscheidenden Hürden. Erstens droht der technologische Kern – das Umwandeln von PDFs in Quizze mittels KI – zu einer reinen „Commodity“ zu werden. Da große Sprachmodelle (LLMs) rasant mächtiger werden, könnten generische Unternehmenstools diese Funktion bald als Standard-Feature mitliefern. Elephant muss beweisen, dass sich die Plattform unverzichtbar tief in echte Qualitätssicherungs- und Produktionsprozesse verwebt.

Zweitens bleibt der Faktor Mensch das größte Risiko. Software für den Shopfloor scheitert selten am Management, sondern oft an der fehlenden Akzeptanz der Belegschaft. Wenn die App im stressigen Arbeitsalltag nicht als spürbare Entlastung wahrgenommen wird, nützt auch die beste KI wenig.

Unser Fazit

Ein valider Ansatz unter hohem Konkurrenzdruck Elephant hat mit EnBW und Wepa die idealen Partner gefunden, um die Praxistauglichkeit in großen Strukturen unter Beweis zu stellen. Die 5 Millionen Euro geben den nötigen Runway. Dennoch ist der technologische Burggraben schmal. Um langfristig gegen internationale Schwergewichte zu bestehen, muss Elephant mehr sein als nur ein komfortabler Content-Generator. Der echte Härtetest beginnt an der Werkbank.

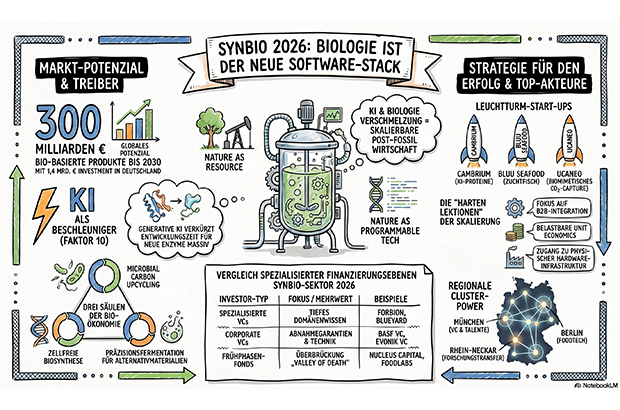

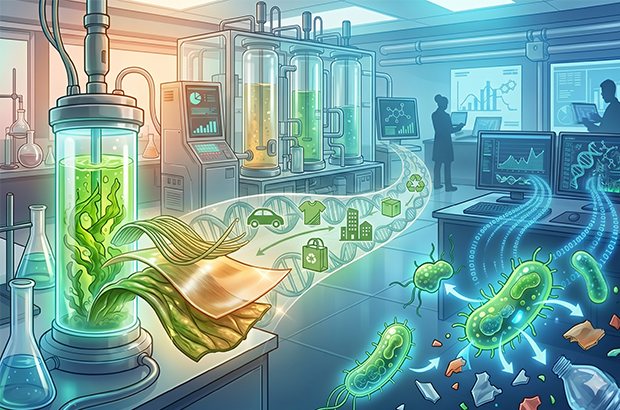

SynBio-Start-up-Report 2026

Biologie ist der neue Code: Wie Synthetische Biologie (SynBio) die Industrie neu programmiert und welche Start-ups dabei hierzulande federführend sind.

Die Vision einer post-fossilen Wirtschaft ist im Jahr 2026 keine bloße Utopie mehr, sondern eine präzise Ingenieursleistung. Wir erleben den Moment, in dem die Natur von einer Ressource, die wir ausbeuten, zu einer Technologie wird, die wir programmieren. In den Laboren der Republik entstehen heute Lösungen für die größten Versorgungskrisen unserer Zeit. Der Aufstieg der Synthetischen Biologie (SynBio) markiert den Übergang vom Zeitalter der Petrochemie in das Zeitalter der Biomanufaktur – eine Transformation, die so tiefgreifend ist wie die industrielle Revolution, jedoch mit der Geschwindigkeit der digitalen Transformation erfolgt.

Wenn Bits auf Atome treffen

Der SynBio-Markt ist 2026 in eine Phase der industriellen Skalierung eingetreten. Aktuelle Analysen der KfW sowie Branchenberichte von BCG beziffern das globale Marktpotenzial für bio-basierte Produkte bis Ende des Jahrzehnts auf über 300 Milliarden Euro. Allein in Deutschland ist das Investitionsvolumen in DeepTech-BioTech-Start-ups im vergangenen Geschäftsjahr laut Bitkom-Daten auf einen Rekordwert von 1,4 Milliarden Euro gestiegen. Der entscheidende technologische Katalysator ist die Verschmelzung von Generativer KI und Biologie. Dank Modellen, die Proteinfaltungen präziser vorhersagen können, als es je ein menschlicher Forscher vermochte, wurde die Entwicklungszeit für neue Enzyme um den Faktor zehn verkürzt. Die Biologie wird damit endgültig zum „Software-Stack“, bei dem Design-Build-Test-Learn-Zyklen in digitalisierten Bio-Gießereien automatisiert ablaufen.

Jenseits der Petrischale: Die Treiber der Bio-Ökonomie

Drei spezifische Sub-Sektoren dominieren in diesem Jahr die Agenda der Investor*innen. An erster Stelle steht die zellfreie Biosynthese, bei der komplexe Moleküle ohne den Einsatz lebender Zellen produziert werden, was die Skalierbarkeit massiv erhöht. Pioniere wie das US-Unternehmen Solugen haben hier den Weg geebnet, doch deutsche Akteure ziehen in der Effizienz der Bioreaktor-Steuerung nach. Ein zweiter massiver Treiber ist das Microbial Carbon Upcycling: Mikroben werden so programmiert, dass sie industrielles CO2 direkt in hochwertige Proteine oder Kunststoffe umwandeln. Hier verschmelzen Klimaschutz und Produktion zu einer Einheit. Drittens sehen wir den Siegeszug der Biomanufaktur bei Alternativmaterialien – sei es durch Biomasse-Fermentation für Lederersatz aus Myzel oder durch echte Präzisionsfermentation, bei der etablierte Akteure wie die bayrische AMSilk zeigen, dass programmierte Spinnenseide-Proteine bereits in Serie gehen können. Die Lieferkette der Mode- und Automobilindustrie wird durch diese Biopolymere radikal dekarbonisiert.

Die harten Lektionen der Skalierung

Der Weg zum Erfolg war jedoch von schmerzhaften Rückschlägen gepflastert. Der prominente Crash des einstigen Branchenlieblings Amyris im Jahr 2023 wirkt bis heute als warnendes Beispiel nach. Das Unternehmen scheiterte trotz Milliardenbewertung an der Komplexität der vertikalen Integration und dem Versuch, gleichzeitig Technologieplattform und B2C-Marke zu sein. Für heutige Gründer*innen haben sich daraus vier fatale Fallstricke herauskristallisiert, die über Sieg oder Niederlage entscheiden. Erstens: Die Ignoranz gegenüber den Unit Economics. Ein Produkt, das im 5-Liter-Maßstab funktioniert, muss im 50.000-Liter-Kessel nicht zwangsläufig profitabel sein. Zweitens: Das „Regulatorik-Vakuum“. Wer die EU-Novel-Food-Verordnungen oder GVO-Richtlinien nicht von Tag eins an in die Produktentwicklung einplant, riskiert Jahre des Stillstands. Drittens: Die Fokussierung auf den Endkonsument*innen statt auf B2B-Integration. Der wahre Hebel liegt in der Lizenzierung von Prozessen an die Industrie. Viertens: Die Unterschätzung der Hardware-Komponente. SynBio ist kein reines Software-Business; ohne Zugang zu physischer Infrastruktur bleibt jede Innovation im Labor gefangen.

Deutschlands Bio-Cluster

Deutschland hat sich im internationalen Vergleich als einer der stärksten Hubs für SynBio etabliert, getrieben durch eine einzigartige Verzahnung von Spitzenforschung und industrieller Basis. In München und dem angeschlossenen IZB Martinsried konzentriert sich die größte Dichte an Venture Capital und Talenten, eng flankiert durch die Exzellenz-Cluster der TU München. Berlin hat sich durch spezialisierte Inkubatoren wie den ProVeg Incubator, Atlantic Food Labs (FoodLabs) und den Science Park Berlin-Buch zum absoluten Zentrum für FoodTech und zelluläre Landwirtschaft entwickelt. Ein weiterer Hotspot ist das Rhein-Neckar-Delta rund um Heidelberg, wo das European Molecular Biology Laboratory (EMBL) und der BioRN-Cluster eine Brücke zwischen Grundlagenforschung und Marktreife schlagen. Aachen punktet mit der RWTH und einer starken Fokussierung auf Bio-Verfahrenstechnik, während der Raum Darmstadt/Frankfurt durch die Nähe zu Giganten wie Merck und die TU Darmstadt als Kraftzentrum für die industrielle Bioproduktion gilt.

Investor*innen-Radar

Die Finanzierungslandschaft hat sich spezialisiert. Wir unterscheiden im Jahr 2026 vier Ebenen der Kapitalgeber*innen. Die spezialisierten VCs wie Forbion, BlueYard Capital oder Sofinnova Partners bringen das notwendige tiefe Domänenwissen mit. Auf der zweiten Ebene stehen Top-Tier Generalisten wie HV Capital und Earlybird, die SynBio zunehmend als Teil ihrer Dekarbonisierungs-Strategie begreifen. Besonders kritisch für die Skalierung sind die Corporate VCs der Industrie, allen voran BASF Venture Capital und Evonik Venture Capital, die nicht nur Geld, sondern auch Abnahmegarantien und technisches Know-how bieten. In der Frühphase bewegen zudem spezialisierte Mikro-Fonds wie Nucleus Capital oder erfahrene ClimateTech-Angels den Markt, oft organisiert in Syndikaten, die das „Valley of Death“ zwischen Labor und Prototyp überbrücken

Die Top-Start-ups: Unsere Must-Watch-Liste 2026

Für die folgende Auswahl der Start-ups haben wir Unternehmen analysiert, die nach 2019 in Deutschland gegründet wurden. Die Auswahlkriterien basieren auf der technologischen Tiefe (IP-Portfolio), dem Reifegrad der Pilotierung, der Validierung durch renommierte Investoren sowie dem Potenzial, bestehende industrielle Lieferketten systemisch zu verändern. Diversität in Gründungsteams und die Skalierbarkeit der zugrunde liegenden Bio-Plattform waren weitere entscheidende Faktoren.

- Cambrium (Berlin, gegründet 2020): Das Team um Dr. Mitchell Duffy nutzt eine KI-gestützte Designplattform, um neuartige Proteine mit molekularen Funktionen zu entwickeln, die in der Natur so nicht vorkommen. Ihr Fokus liegt auf der Kosmetik- und Textilindustrie, wo sie petrochemische Inhaltsstoffe durch bio-designte Alternativen ersetzen. Mit massiven Finanzierungsrunden, angeführt von Tech-Schwergewichten wie Essential Capital und dem Google-KI-Fonds Gradient Ventures, gilt Cambrium als Leuchtturm für eine neue Generation von Biomaterial-Zulieferern, die aus digitalem Code physische Hochleistungsprodukte erschaffen.

- Bluu Seafood (Berlin, gegründet 2020): Gegründet von Dr. Sebastian Rakers und Simon Fabich, ist Bluu einer der führenden europäischen Akteure im Bereich kultivierter Fisch. Durch die Kultivierung echter Fischzellen im Bioreaktor adressieren sie die Überfischung der Meere. Nach signifikanten Investments durch Lead-Investor Sparkfood sowie LBBW VC und Delivery Hero Ventures steht das Unternehmen kurz vor der ersten Marktzulassung in Singapur und den USA.

- Colipi (Hamburg, gegründet 2022): Das Spin-off der TU Hamburg, geführt von Maximilian Webers, nutzt eine patentierte Gasfermentationstechnologie, um CO2 in nachhaltige Öle und Lipide umzuwandeln. Der USP von Colipi ist die Nutzung von industriellen Abgasströmen als Rohstoff, was die Produktion extrem kosteneffizient macht. Sie konnten sich frühzeitig die Unterstützung von Top-Investoren wie dem High-Tech Gründerfonds (HTGF) und dem Innovationsstarter Fonds Hamburg sichern.

- Kynda (Jelmstorf, gegründet 2019): Ursprünglich als Keen 4 Greens von Daniel MacGowan-von Holstein und Franziskus Schnabel gegründet, bietet Kynda Plug-and-Play-Fermentationssysteme für die Lebensmittelindustrie an. Als B2B-Technologiepartner stellen sie modulare Bioreaktoren und Pilzkulturen bereit, mit denen Hersteller ihre eigenen Produktionsabfälle direkt vor Ort kostengünstig in Mykoproteine umwandeln können. Eine kürzliche 3-Millionen-Euro-Seed-Finanzierung – angeführt vom VC EnjoyVenture und massiv flankiert durch ein strategisches Investment des Geflügel-Giganten PHW-Gruppe – unterstreicht das enorme Skalierungspotenzial dieses Kreislauf-Modells.

- Nosh.bio (Berlin, gegründet 2022): Das Team um Tim Fronzek nutzt Pilzbiomasse als funktionalen Inhaltsstoff für die Lebensmittelindustrie, um Clean-Label-Produkte ohne Zusatzstoffe zu ermöglichen. Der technologische Vorsprung von Nosh.bio liegt in der Geschwindigkeit des Fermentationsprozesses. Frühphasen-Finanzierungen durch Earlybird unterstreichen das hohe Vertrauen in das Skalierungspotenzial.

- Ucaneo (Berlin, gegründet 2022): Das Team um Florian Tiller und Carla Glassl beweist, dass Synthetische Biologie auch beim Direct Air Capture (DAC) den Unterschied macht. Statt energieintensiver chemischer Filter nutzt Ucaneo eine biomimetische Technologie: Sie setzen das Enzym Carboanhydrase ein – eines der schnellsten Enzyme der Natur –, um CO2 bei Raumtemperatur direkt aus der Umgebungsluft zu binden. Mit starken Frühphasen-Finanzierungen durch DeepTech-Fonds wie Nucleus Capital und der US-amerikanischen Grantham Foundation baut Ucaneo derzeit in Berlin-Marienfelde ihre erste industrielle Testanlage auf.

- Insempra (München, gegründet 2021): Das Team um Gründer Jens Klein hat sich zum Ziel gesetzt, die massive Abhängigkeit der globalen Lieferketten von der Petrochemie zu beenden. Über ihre B2B-Technologieplattform nutzen sie Präzisionsfermentation, um maßgeschneiderte Inhaltsstoffe für die Kosmetik-, Lebensmittel- und Textilbranche quasi zu programmieren – von bio-basierten Lipiden und Aromen bis hin zu neuartigen Proteinfasern. Eine hochkarätige Finanzierungsrunde, angeführt von europäischen DeepTech-Schwergewichten wie EQT Ventures und BlueYard Capital, unterstreicht den Anspruch von Insempra, ein globaler industrieller Zulieferer der nächsten Generation zu werden.

Ausblick & Fazit: Der globale Wettlauf

Der Blick über den Tellerrand zeigt: Wir stehen in einem globalen Systemwettbewerb. In den USA treibt die per Executive Order erlassene „National Biotechnology and Biomanufacturing Initiative“ Milliardeninvestitionen in die heimische Infrastruktur, flankiert von Pionieren, die dort und in Frankreich (wie Biomemory) bereits an der Verschmelzung von SynBio und DNA-Datenspeicherung arbeiten. In Asien, insbesondere in China und Singapur, werden derweil regulatorische Hürden in Rekordzeit abgebaut, um die Marktführerschaft bei der Biomanufaktur zu übernehmen. Flankiert wird dies von Hubs wie Israel, die mit massivem VC-Kapital den globalen Markt für kultivierte Proteine dominieren wollen.

Das Fazit für das Jahr 2026: Biologie ist die Infrastruktur der Zukunft. Für Gründer*innen bedeutet dies, dass die Zeit der reinen Plattform-Versprechen vorbei ist; gefragt sind konkrete Produkte und belastbare Unit Economics. Für Investor*innen bietet SynBio die seltene Chance, echte „Impact-Rendite“ zu erzielen, indem sie Industrien transformieren, die über Jahrzehnte festgefahren waren. Wer heute den Code der Natur versteht und skalieren kann, wird die Welt von morgen nicht nur verstehen, sondern neu bauen.

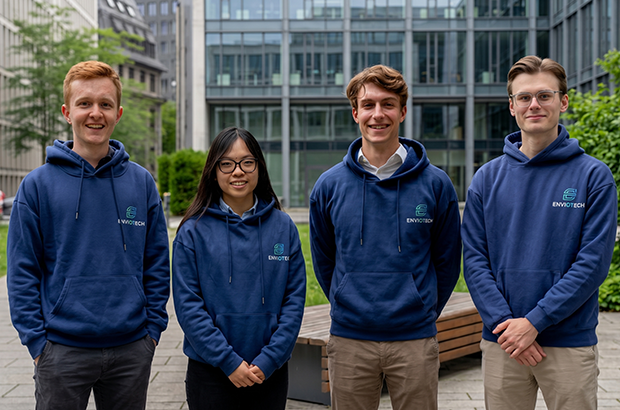

ENVIOTECH sichert sich Millionenfinanzierung für intelligente öffentliche Straßenbeleuchtung

Das Frankfurter Start-up ENVIOTECH rund um Adrian Rhaese, Linh Pham, Dustin Arnold und Peter Kletsko hat eine Pre-Seed-Runde in Höhe von einer Million Euro abgeschlossen, um öffentliche Straßenbeleuchtung intelligent nachzurüsten. Doch der Markt für kommunale Infrastruktur ist hart umkämpft und bürokratisch. Kann das junge Team die öffentlichen Verwaltungen überzeugen?

Es ist ein klassisches Gründer*innen-Narrativ: Aus einem persönlichen Schmerzpunkt entsteht eine Geschäftsidee. Im Fall von ENVIOTECH war es ein Fahrradunfall. Der beste Freund von Mitgründer Adrian Rhaese verunglückte, weil in einer deutschen Stadt die Straßenlaternen aufgrund gestiegener Stromkosten abgeschaltet worden waren. Dieser Vorfall weckte bei Rhaese das Unverständnis darüber, dass in einem wirtschaftlich starken Land ausgerechnet an der Sicherheit gespart wird – und legte den Grundstein für das Smart-City-Start-up.

Bye-bye Bankenturm: Der Sprung ins kalte Wasser

Anstatt ihren als sicher geltenden Karriereweg fortzusetzen, verließen Adrian Rhaese und Mitgründerin Linh Pham ihre Positionen als duale Studierende bei der Deutschen Bank. Sie entschieden sich bewusst für das unternehmerische Risiko, um reale Infrastrukturprobleme zu lösen.

Eine erste Bestätigung für diesen Schritt erhielt das junge Team durch die Aufnahme in das EWOR Fellowship. Daniel Dippold, Gründer und CEO von EWOR, bescheinigt dem Team den richtigen Fokus: „Unspektakuläre Infrastruktur gewinnt langfristig fast immer. Straßenbeleuchtung ist nicht glamourös, aber sie ist allgegenwärtig, unverzichtbar und aus keiner Stadt wegzudenken.“

Plug-and-Play am Lichtmast: Das 15-Minuten-Update

Die technische Lösung von ENVIOTECH setzt auf Pragmatismus: Anstatt Laternen kostenintensiv komplett auszutauschen, bietet das Unternehmen ein Retrofit-System an. Das Produkt soll sich laut Unternehmensangaben in unter 15 Minuten in bestehende Leuchten integrieren lassen.

Die nachgerüsteten Laternen kommunizieren als Mesh-Netzwerk miteinander und dimmen das Licht KI-gesteuert und bedarfsgerecht anhand von Bewegungserkennung. Das Startup verspricht dadurch Energieeinsparungen von bis zu 80 Prozent; gleichzeitig soll die öffentliche Sicherheit erhöht werden. Kommunen erhalten so die Möglichkeit, ihre Beleuchtung zentral zu steuern und in Echtzeit zu überwachen.

Um das Konzept in die Fläche zu tragen, konnte ENVIOTECH nun eine Pre-Seed-Finanzierung in Höhe von 1 Million Euro einsammeln. Angeführt wird die Runde passenderweise vom ehemaligen Co-CEO der Deutschen Bank, Jürgen Fitschen. Ergänzt wird das Konsortium durch Ex-MAN-CEO Joachim Drees, Alexander Eyhorn (Gründer von Bidirex) und Danilo Jovicic-Albrecht (Mitgründer des auf Kommunen spezialisierten Startups Vialytics). Mit dem frischen Kapital sollen Pilotprojekte forciert und das Technologieportfolio weiterentwickelt werden.

Der Endgegner heißt B2G-Markt: David gegen die Industrie-Goliaths

So einleuchtend die Technologie klingt, das Geschäftsmodell von ENVIOTECH steht vor gewaltigen Hürden. Der B2G-Markt (Business-to-Government) ist für Start-ups extrem schwierig. Kommunen, die ENVIOTECHs primäre Zielgruppe darstellen, arbeiten mit langen Budgetzyklen und streng regulierten öffentlichen Ausschreibungsverfahren. Bis ein Pilotprojekt zu einem flächendeckenden Rollout führt, vergehen oft Jahre.

Darüber hinaus agiert das Start-up nicht im luftleeren Raum. Der Smart-Lighting-Markt wird von Industriegiganten wie Signify oder Schréder dominiert, die längst eigene IoT-Lichtsteuerungssysteme anbieten. Auch andere Start-ups wie Tvilight oder Icegateway haben das Potenzial vernetzter Straßenbeleuchtung erkannt.

Der entscheidende USP von ENVIOTECH muss daher in der Geschwindigkeit und Einfachheit liegen: Gelingt die versprochene rasante Installation und können Kommunen die Lösung ohne massive Tiefbauarbeiten testen, hat das Start-up einen echten Wettbewerbsvorteil. Besonders klug ist hierbei die Auswahl der Investor*innen: Mit Drees und Jovicic-Albrecht hat das Gründerduo Köpfe an Bord geholt, die wissen, wie man komplexe Produkte an die öffentliche Hand verkauft. Schafft es ENVIOTECH, den extrem zähen Vertriebszyklus öffentlicher Verwaltungen zu knacken, könnte das Unternehmen zu einem hochrentablen Hidden Champion heranwachsen.

Württemberger Medien: Nachhaltige Wachstumsstrategien

Wie die Württemberger Medien Marketing Agentur Unternehmen mit datengetriebenen Strategien und klarer Positionierung unterstützt.

Digitale Sichtbarkeit ist heute für Unternehmen kein optionaler Erfolgsfaktor mehr, sondern eine Grundvoraussetzung. Märkte werden transparenter, Wettbewerber sichtbarer und Kunden anspruchsvoller. Wer sich behaupten will, muss nicht nur präsent sein, sondern gezielt kommunizieren, analysieren und optimieren. Genau an dieser Schnittstelle zwischen Strategie, Technologie und Kommunikation setzt die wtv Online Marketing Agentur an.

Das Unternehmen hat sich darauf spezialisiert, digitale Potenziale strukturiert zu erschließen und für seine Kunden messbar zu machen. Dabei geht es nicht um kurzfristige Maßnahmen oder einzelne Kampagnen, sondern um nachhaltige Strategien, die Wachstum langfristig unterstützen.

Von der Idee zur klaren digitalen Strategie

Viele Unternehmen starten mit einzelnen Marketingmaßnahmen, ohne eine übergeordnete Strategie zu verfolgen. Social-Media-Kanäle werden aufgebaut, Anzeigen geschaltet oder Inhalte produziert – oft ohne klare Zielsetzung oder langfristige Planung. Das Ergebnis: hohe Aufwände bei begrenzter Wirkung.

Die Württemberger Medien Agentur verfolgt bewusst einen anderen Ansatz. Im Mittelpunkt steht zunächst die Analyse. Bevor Maßnahmen umgesetzt werden, geht es darum, das Unternehmen, die Zielgruppe und den Markt genau zu verstehen.

Dazu gehören unter anderem:

- die Definition klarer Ziele und Zielgruppen

- die Analyse bestehender Marketingaktivitäten

- die Bewertung von Wettbewerbern und Marktposition

- die Identifikation von Potenzialen und Schwachstellen

Auf dieser Grundlage entsteht eine individuelle Strategie, die nicht nur kurzfristige Erfolge ermöglicht, sondern langfristig trägt.

Datenbasierte Entscheidungen statt Bauchgefühl

Ein wesentlicher Unterschied moderner Online-Marketing-Ansätze liegt in der Nutzung von Daten. Während Marketing früher oft stark von Erfahrung und Intuition geprägt war, stehen heute umfangreiche Analysemöglichkeiten zur Verfügung.

Die Württemberger Medien Agentur nutzt diese Möglichkeiten gezielt, um fundierte Entscheidungen zu treffen. Daten werden nicht nur gesammelt, sondern interpretiert und in konkrete Maßnahmen übersetzt. Dadurch lassen sich Maßnahmen kontinuierlich optimieren und Budgets effizient einsetzen.

Diese Arbeitsweise bringt mehrere Vorteile mit sich:

- bessere Planbarkeit von Marketingmaßnahmen

- transparente Erfolgsmessung

- gezielte Optimierung einzelner Kanäle

- langfristige Skalierbarkeit von Strategien

Gerade für wachsende Unternehmen ist diese Transparenz ein entscheidender Faktor.

Ganzheitlicher Blick auf digitale Kanäle

Online-Marketing besteht heute aus einer Vielzahl unterschiedlicher Disziplinen. Suchmaschinenoptimierung, Performance Marketing, Content-Strategie und Social Media greifen ineinander und beeinflussen sich gegenseitig.

Die Württemberger Medien Agentur betrachtet diese Bereiche nicht isoliert, sondern als Teil eines Gesamtsystems. Ziel ist es, die einzelnen Kanäle sinnvoll miteinander zu verknüpfen und so eine konsistente Markenkommunikation zu schaffen.

Dabei werden unter anderem folgende Bereiche integriert:

- Suchmaschinenoptimierung (SEO) für nachhaltige Sichtbarkeit

- Webdesign und Website-Entwicklung für einen professionellen digitalen Auftritt

- Digitale Mitarbeitergewinnung über zielgerichtete Online-Kampagnen

- Ganzheitliche strategische Beratung zur digitalen Sichtbarkeit und Kundengewinnung

Durch diese Verzahnung entsteht ein Marketingansatz, der sowohl kurzfristige Ergebnisse als auch langfristige Wirkung ermöglicht.

Fokus auf messbare Ergebnisse

Ein zentraler Anspruch der Württemberger Medien ist die Messbarkeit von Erfolg. Marketing wird nicht als kreativer Selbstzweck verstanden, sondern als strategisches Instrument zur Erreichung konkreter Unternehmensziele.

Das bedeutet, dass jede Maßnahme klar definierten Kennzahlen zugeordnet wird. Ob Traffic, Conversion-Rate oder Umsatz – die Ergebnisse werden kontinuierlich überprüft und ausgewertet.

Diese Transparenz schafft Vertrauen und ermöglicht es Kunden, ihre Investitionen nachvollziehbar zu steuern. Gleichzeitig bildet sie die Grundlage für eine kontinuierliche Weiterentwicklung der Strategie.

Zusammenarbeit auf Augenhöhe

Neben fachlicher Expertise spielt auch die Zusammenarbeit eine entscheidende Rolle. Die Württemberger Medien Agentur versteht sich nicht als externer Dienstleister im klassischen Sinne, sondern als strategischer Partner.

Das zeigt sich vor allem in der Kommunikation. Projekte werden eng mit den Kunden abgestimmt, Entscheidungen transparent getroffen und Entwicklungen regelmäßig besprochen. Ziel ist es, gemeinsam Lösungen zu entwickeln, die zum jeweiligen Unternehmen passen.

Diese partnerschaftliche Herangehensweise bringt mehrere Vorteile:

- klare Abstimmung von Zielen und Erwartungen

- schnelle Anpassung an Veränderungen

- langfristige Zusammenarbeit statt kurzfristiger Projekte

- bessere Integration in bestehende Unternehmensstrukturen

Gerade in dynamischen Märkten ist diese Flexibilität ein wichtiger Erfolgsfaktor.

Anpassungsfähigkeit in einem dynamischen Umfeld

Die digitale Welt verändert sich kontinuierlich. Neue Plattformen entstehen, Algorithmen werden angepasst und Nutzerverhalten entwickelt sich weiter. Für Unternehmen bedeutet das, dass Strategien regelmäßig überprüft und angepasst werden müssen.

Die Württemberger Medien Agentur begegnet dieser Dynamik mit einem flexiblen Ansatz. Statt starrer Konzepte setzt sie auf kontinuierliche Optimierung und Anpassung. Entwicklungen werden frühzeitig erkannt und in die Strategie integriert.

Dadurch bleiben Kunden nicht nur wettbewerbsfähig, sondern können neue Chancen aktiv nutzen.

Branchenübergreifende Erfahrung

Ein weiterer Vorteil der Württemberger Medien Online Marketing Agentur liegt in ihrer branchenübergreifenden Erfahrung. Zu den Kunden des Unternehmens zählen lokale und regionale Dienstleister, Handwerks- und Gewerbebetriebe sowie Unternehmen aus dem Mittelstand. Dadurch entsteht ein breites Verständnis für verschiedene Geschäftsmodelle, Zielgruppen und Marktmechaniken.

Diese Vielfalt hilft dabei, funktionierende Strategien nicht isoliert zu betrachten, sondern sinnvoll auf andere Bereiche zu übertragen. Was bei einem Dienstleistungsunternehmen zu mehr Sichtbarkeit und Anfragen führt, kann, richtig angepasst, auch für Handwerks- und Gewerbebetriebe sehr gut funktionieren. Gleichzeitig entstehen durch diese Perspektivwechsel oft innovative Ansätze, die über klassische Lösungen hinausgehen.

Dennoch bleibt jede Strategie individuell. Die Württemberger Medien Agentur setzt nicht auf standardisierte Konzepte, sondern passt Maßnahmen präzise an die jeweiligen Anforderungen an. Marktumfeld, Wettbewerbssituation und Zielgruppe werden dabei ebenso berücksichtigt wie interne Strukturen und Ressourcen des Kunden.

So entsteht ein ausgewogenes Verhältnis zwischen Erfahrung und Individualität – eine Kombination, die es ermöglicht, sowohl effizient als auch kreativ zu arbeiten und nachhaltige Ergebnisse zu erzielen.

Nachhaltiges Wachstum statt kurzfristiger Erfolge

Im Zentrum der Arbeit steht ein klares Ziel: nachhaltiges Wachstum. Während viele Marketingmaßnahmen auf schnelle Ergebnisse ausgerichtet sind, verfolgt die Württemberger Medien Agentur einen langfristigen Ansatz. Es geht nicht darum, kurzfristig Aufmerksamkeit zu erzeugen, sondern darum, stabile Strukturen aufzubauen, die dauerhaft funktionieren.

Das bedeutet, dass nicht nur einzelne Kampagnen optimiert werden, sondern das gesamte digitale Fundament eines Unternehmens gestärkt wird. Sichtbarkeit in Suchmaschinen, eine klare Markenpositionierung und eine gezielte Kundenansprache werden Schritt für Schritt aufgebaut und kontinuierlich weiterentwickelt.

Dabei spielen mehrere Faktoren zusammen. Eine technisch optimierte Website sorgt für eine bessere Auffindbarkeit, ein professioneller Markenauftritt stärkt die Außenwirkung und datenbasierte Kampagnen bringen gezielt Reichweite. Durch diese Kombination entsteht ein System, das nicht von einzelnen Maßnahmen abhängig ist, sondern als Ganzes wirkt.

Ein weiterer Vorteil dieses Ansatzes liegt in der Planbarkeit. Unternehmen erhalten eine klare Perspektive, wie sich ihre Marketingaktivitäten entwickeln und welche Ergebnisse realistisch zu erwarten sind. Gleichzeitig bleibt genügend Flexibilität, um auf Veränderungen im Markt zu reagieren und neue Chancen zu nutzen.

Dieser Fokus auf langfristige Entwicklung sorgt dafür, dass Unternehmen nicht nur kurzfristig wachsen, sondern sich nachhaltig im Wettbewerb positionieren können.

Fazit

Die Anforderungen an modernes Online-Marketing sind heute komplexer denn je. Unternehmen müssen sich in einem dynamischen Umfeld behaupten, ihre Zielgruppen verstehen und gleichzeitig effizient arbeiten. Gleichzeitig steigt der Druck, Marketingmaßnahmen nicht nur umzusetzen, sondern auch deren Wirkung nachvollziehbar zu machen.

Die Württemberger Medien Marketing Agentur zeigt, wie sich diese Herausforderungen strukturiert und zielgerichtet angehen lassen. Durch die Kombination aus datenbasierter Analyse, strategischer Planung und kontinuierlicher Optimierung entstehen Lösungen, die messbare Ergebnisse liefern und gleichzeitig langfristig tragen.

Besonders hervorzuheben ist der ganzheitliche Ansatz. Statt isolierter Maßnahmen entwickelt die Agentur ein umfassendes System, in dem alle digitalen Kanäle sinnvoll miteinander verknüpft sind. Dadurch wird nicht nur kurzfristige Sichtbarkeit erzeugt, sondern eine stabile Grundlage für nachhaltiges Wachstum geschaffen.

Für Unternehmen, die ihre digitale Präsenz gezielt ausbauen und langfristig stärken möchten, bietet dieser Ansatz eine klare Orientierung. Er verbindet Strategie, Technologie und Kommunikation zu einem durchdachten Gesamtbild – und schafft damit die Voraussetzungen für kontinuierlichen Erfolg in einem sich ständig verändernden Marktumfeld.

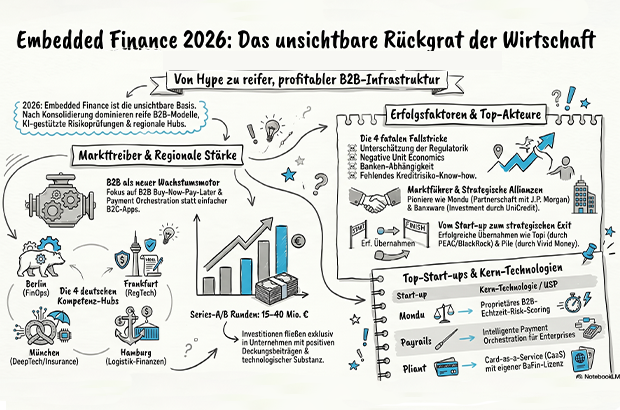

Embedded-Finance-Start-up-Report 2026

Der unsichtbare Bankensektor: Wie Embedded Finance und die dazugehörigen Start-ups die Wirtschaft des Jahres 2026 prägen.

Einst war es das große Versprechen für eine Handvoll hipper Neobanken, heute ist es das unsichtbare Rückgrat der europäischen Wirtschaft: Embedded Finance. Im Jahr 2026 wird das Marktwachstum längst nicht mehr von der fixen Idee isolierter Bank-Apps dominiert, denn jedes zukunftsorientierte Unternehmen ist mittlerweile selbst zu einem/einer Finanzdienstleister*in geworden. Ob Software-as-a-Service-Anbieter*in, Logistik-Plattform oder Marktplatz – die nahtlose Integration von Zahlungen, Krediten und Versicherungen in nicht-finanzielle Kund*innenreisen ist das neue Paradigma.

Dieser Report beleuchtet eine Branche, die den „Sturm der Konsolidierung“ überlebt hat und nun mit reifen Geschäftsmodellen und echten Profiten die Architektur der modernen Wirtschaft neu programmiert.

Vom Hype zur fundamentalen Reife

Nach den massiven Zinsanpassungen und regulatorischen Aufräumarbeiten der Jahre 2023 und 2024 zeichnet der Embedded-Finance-Markt heute ein Bild robuster Reife. Renommierte Analystenhäuser wie Bain & Company und Dealroom haben diese Entwicklung früh vorgezeichnet: Der globale Markt für Embedded-Finance-Dienstleistungen hat sich in ein Multimilliarden-Segment verwandelt, dessen europäisches Transaktionsvolumen mittlerweile signifikante Teile des digitalen B2B- und B2C-Handels stützt. Der technologische Haupttreiber dieser neuen Ära ist unbestreitbar die künstliche Intelligenz, genauer gesagt proprietäre Machine-Learning-Modelle, die Risikobewertungen in Millisekunden durchführen und Transaktionsströme dynamisch optimieren. Investor*innen honorieren diese technologische Tiefe: Wir sehen heute höchst realistische Series-A- und Series-B-Runden im Bereich von 15 bis 40 Millionen Euro für Start-ups, die nachweislich positive Deckungsbeiträge aufweisen. Es fließt wieder signifikant Kapital, doch es fließt exklusiv in Substanz und Skalierbarkeit, nicht mehr in reines Marketing.

Die neuen Treiber: B2B, Vertikalisierung und Orchestrierung

Wenn man über das Offensichtliche wie einfache White-Label-Kreditkarten hinausblickt, dominieren im Jahr 2026 drei spezifische Sub-Sektoren den Markt. Allen voran steht B2B Buy-Now-Pay-Later, eine Disziplin, die das traditionelle, schwerfällige Factoring abgelöst hat und nun direkt in B2B-Checkouts und Beschaffungsnetzwerke integriert ist. Ein weiterer massiver Treiber ist die sogenannte Payment Orchestration für vertikale SaaS-Lösungen. Hier werden komplexe, branchenspezifische Zahlungsflüsse – etwa im Handwerk oder in der Gastronomie – automatisiert im Hintergrund abgewickelt. Zuletzt etabliert sich Embedded Insurance zunehmend im Industriekontext, wo Maschinen nicht mehr nur geleast, sondern im selben Atemzug transaktionsbasiert versichert werden. Pioniere wie die Berliner Mondu oder auch europäische Schwergewichte wie Swan haben den Weg für diese hochspezialisierten Infrastruktur-Layer geebnet und gezeigt, wie tiefgreifend diese Geschäftsmodelle in die Wertschöpfungsketten der Realwirtschaft eingreifen.

Die Lektionen der BaaS-Krise

Doch dieser Reifegrad wurde teuer erkauft. Der Beinahe-Kollaps des britischen Banking-as-a-Service-Pioniers Railsr und die drastischen BaFin-Sonderprüfungen samt Wachstumsbeschränkungen bei etablierten deutschen Playern wie Solaris in den Jahren zuvor haben den Markt fundamental erschüttert. Der Traum, Finanzdienstleistungen wie einfache Legosteine zusammenzustecken, kollidierte brutal mit der harten Realität des Bankwesens.

Aus diesen gescheiterten Hoffnungen lassen sich für heutige Gründer*innen vier konkrete, fatale Fallstricke ableiten. Der erste und wichtigste ist die eklatante Unterschätzung der Regulatorik; Compliance lässt sich nicht auslagern, und Aufsichtsbehörden dulden keine agilen Versuch-und-Irrtum-Prozesse bei der Geldwäscheprävention. Der zweite Fallstrick ist die Falle der negativen Unit Economics im B2C-Sektor, wo exorbitante Kund*innenakquisitionskosten oft nur durch kontinuierliches VC-Geld gedeckt wurden. Drittens das Klumpenrisiko der Abhängigkeit von einer einzigen Partnerbank, deren Ausfall das eigene Start-up über Nacht handlungsunfähig macht. Und viertens die Fehlannahme, dass Technologie allein ausreicht; wer heute kein tiefes Verständnis für klassisches Bilanzstruktur- und Kreditrisikomanagement mitbringt, scheitert unweigerlich.

Das deutsche Netzwerk: Die Schmieden der Infrastruktur

Deutschland hat sich in dieser Konsolidierungsphase als einer der resilientesten Standorte in Europa bewiesen, getragen von vier essenziellen Hubs. Berlin verteidigt dabei seinen Status als unangefochtene Hauptstadt für FinOps und B2B-Zahlungsinfrastruktur, massiv befeuert durch die Talent-Pipelines der TU Berlin sowie das dichte Netzwerk an Serial Entrepreneurs aus der N26- und SumUp-Schule. Frankfurt am Main bildet den unverzichtbaren regulatorischen Gegenpol; hier, im Schatten von EZB und BaFin, entstehen im Umfeld des TechQuartiers und der Frankfurt School of Finance and Management jene Start-ups, die komplexe Compliance- und Treasury-Architekturen für Großbanken bauen. München dominiert den Bereich DeepTech und Embedded Insurance im industriellen B2B-Kontext, was auf die herausragende Stellung des Center for Digital Technology and Management (CDTM) und die enge Verzahnung mit der ansässigen Versicherungs- und Automobilindustrie zurückzuführen ist. Hamburg schließlich hat sich als europäischer Hotspot für Trade Finance und in Logistikketten eingebettete Finanzierungen etabliert, gestützt durch die traditionelle Stärke der Hansestadt im globalen Handel.

Investor*innen-Radar

Das Ökosystem der Geldgeber*innen hat sich im Jahr 2026 stark differenziert und professionalisiert. An der Spitze der spezialisierten VCs agieren Fonds wie FinTech Collective und Motive Ventures (hervorgegangen aus der Übernahme des Berliner VCs embedded/capital), die mit tiefem technologischen Verständnis gezielt in Infrastruktur-Layer investieren. Unter den Top-Tier Generalisten ragen Cherry Ventures, Earlybird und Point Nine heraus, die insbesondere Series-A-Runden bei überzeugenden B2B-SaaS-Modellen anführen.

Ein starker Motor sind zudem Corporate VCs und bankennahe Fonds geworden: CommerzVentures, als unabhängiger Player, treibt Themen wie Climate-Fintech massiv voran, während CVCs der Realwirtschaft wie Allianz X und Porsche Ventures strategisch in Start-ups investieren, die sich nahtlos in ihre eigenen vertikalen Ökosysteme einklinken lassen. In der kritischen Frühphase wird der Markt von einer hochgradig vernetzten Gruppe aus Business Angels angetrieben, die nicht nur erstes Kapital, sondern vor allem regulatorisches Know-how und entscheidende Bankennetzwerke einbringen

Die Top Start-ups (Must-Watch)

Für die nachfolgende Liste der Must-Watch-Unternehmen haben wir strikte Kriterien angelegt. Die Auswahl basiert auf nachgewiesener Marktrelevanz durch echte Kund*innenimplementierungen, einem hohen technologischen Reifegrad und einem diversifizierten Ansatz bei der Lösung komplexer Finanzinfrastrukturprobleme. Zudem war ein nachhaltiges Investoren-Vertrauen in den letzten zwölf Monaten ein Schlüsselfaktor. Wir beleuchten hierbei ausschließlich Start-ups mit Hauptsitz in Deutschland, deren Gründung im Jahr 2020 oder später erfolgte, um die wahre nächste Generation der Branche abzubilden.

Banxware

Das 2020 von Miriam Wohlfarth und Jens Röhrborn gegründete Banxware hat sich als Marktführer für Embedded Lending in Deutschland etabliert. Banxware bietet eine White-Label-Lösung, mit der Marktplätze und Zahlungsdienstleister*innen ihren Händler*innen Sofortkredite basierend auf historischen Umsatzdaten anbieten können. Der USP liegt in der extrem schnellen Risikoprüfung und der nahtlosen API-Integration in bestehende Plattformen. Das enorme Vertrauen der Finanzbranche in dieses Modell spiegelt sich massiv auf Investor*innenseite wider: Neben frühen Leadern wie Element Ventures (heute 13books Capital) ist insbesondere der Einstieg der Großbank UniCredit ein Ritterschlag. Die Bank führte nicht nur die Series-A-Runde an, sondern legte Mitte 2025 mit einem weiteren strategischen Millionen-Investment nach, um die europäische Expansion von Banxware gemeinsam voranzutreiben.

Pliant

Im Jahr 2020 von Malte Rau und Fabian Terner aus der Taufe gehoben, definiert Pliant den Markt für B2B-Kreditkarten und Ausgabenmanagement neu. Das B2B-SaaS-Modell kombiniert eine moderne Karteninfrastruktur mit einer tiefen API-basierten Integration in Buchhaltungs- und ERP-Systeme. Der technologische Vorsprung liegt im eigenen Card-as-a-Service-Angebot (CaaS), das anderen B2B-Plattformen den Launch eigener Kreditkartenprogramme ermöglicht. Ein entscheidender Meilenstein war hierfür der Erhalt der eigenen E-Geld-Lizenz der BaFin, die Pliant die nötige regulatorische Unabhängigkeit verleiht. Unterstützt wird Pliant von namhaften Investoren wie SBI Investment, Alstin Capital – und einem Investment des globalen Schwergewichts PayPal Ventures, das das enorme Skalierungspotenzial der Plattform bestätigt.

Mondu

Die Serial Entrepreneurs Malte Huffmann, Philipp Povel und Gil Danziger gründeten Mondu 2021 und revolutionieren damit den B2B-Zahlungsverkehr. Ihr B2B-BNPL-Modell ermöglicht es Geschäftskund*innen, online wie B2C-Kund*innen auf Rechnung oder in Raten zu kaufen, während der Händler sofort sein Geld erhält. Die Kerntechnologie ist ein proprietäres Echtzeit-Risk-Scoring für Firmenkund*innen. Finanziert wurde diese Vision anfangs von Top-Tier-Fonds wie Valar Ventures und Cherry Ventures. Der ultimative Ritterschlag erfolgte jedoch Ende 2025: Neben dem Erhalt der E-Geld-Lizenz sicherte sich Mondu eine 100-Millionen-Euro-Fazilität von J.P. Morgan Payments inklusive einer strategischen Partnerschaft, um die Buy-Now-Pay-Later-Lösung dem europäischen Kund*innen stamm der US-Großbank anzubieten.

Payrails

Gegründet 2021 von Orkhan Abdullayev, Emre Talay und Nicolas Thouzeau, löst Payrails die Herausforderung der Payment Orchestration. Das FinOps-Start-up baut ein intelligentes Betriebssystem für Zahlungen, das Transaktionen für Enterprise-Kund*innen dynamisch über verschiedene Provider routet, um Kosten zu senken und Autorisierungsraten zu maximieren. Die technologische Brillanz dieser Architektur lockte früh Schwergewichte wie Andreessen Horowitz und EQT Ventures an. Im Sommer 2025 zündete Payrails die nächste Stufe: HV Capital führte eine massive Series-A-Runde über 32 Millionen US-Dollar an, bei der auch alle Top-Tier-Altinvestoren erneut mitzogen, um die globale Expansion der Plattform endgültig zu sichern.

Finmid

Die beiden N26-Alumni Max Schertel und Alexander Talkanitsa starteten Finmid 2021 mit der Mission, jede B2B-Plattform zu einer Finanzierungsquelle zu machen. Ihr Geschäftsmodell fokussiert sich auf Embedded B2B Lending, das speziell auf die Anforderungen von Marktplätzen (wie etwa dem Partner Wolt) zugeschnitten ist – ohne dass diese Plattformen eigenes Kapital bereitstellen oder Risiken tragen müssen. Ihr USP ist die radikale Simplifizierung der B2B-Kreditvergabe durch smarte Echtzeit-Datenverknüpfungen. Angetrieben von einer wuchtigen 23-Millionen-Euro-Series-A-Runde, angeführt vom britischen Fonds Blossom Capital und dem Seed-Lead Earlybird, treibt das Start-up seine aggressive europäische Expansion unaufhaltsam voran.

Topi (Exit)

Charlotte Pallua und Estelle Merle brachten Topi 2021 an den Start, um das Hardware-as-a-Service-Modell in den B2B-Bereich zu integrieren. Über die Plattform können B2B-Kund*innen IT-Equipment flexibel mieten, wobei Topi den gesamten Prozess vom Checkout über das Refinancing bis zum Asset-Management abwickelt. Nachdem Topi mit Händler*innen wie Cyberport massiv skalierte und von Top-VCs wie Index Ventures und Creandum finanziert wurde, erfolgte im Sommer 2025 der strategische Exit: Das FinTech wurde von dem internationalen Leasing-Giganten PEAC Solutions (einem BlackRock-Portfoliounternehmen) übernommen, um das innovative B2B-Mietmodell global in dessen gewaltige Finanzierungsinfrastruktur einzugliedern.

Hakuna

Im Bereich Embedded Insurance schlägt das 2021 von Sebastian Jost, Rupert Mayer und Orhan Köroglu gegründete Hakuna neue Wege ein. Das Start-up bietet Händler*innen eine Plattform für Garantieverlängerungen und Produktschutzversicherungen, nahtlos integriert in den Online- und Offline-Checkout. Der USP ist ein völlig neu gedachtes, digitales Schadensmanagement, das die Abwicklung für Endkund*innen radikal vereinfacht. Finanziert von Top-VCs wie Earlybird und Visionaries Club, hat Hakuna mittlerweile den Sprung ins absolute Enterprise-Segment geschafft: Im Jahr 2025 integrierten Branchenriesen wie Vorwerk, STIHL und Mister Spex die Embedded-Technologie des Start-ups, um ihre eigenen, maßgeschneiderten Produktschutzprogramme europaweit zu skalieren.

Pile (Exit)

Jessica Holzbach startete Pile 2022 und pivotierte das Modell nach dem Krypto-Winter erfolgreich zu einem hochspezialisierten Treasury-Angebot für Start-ups. Die B2B-SaaS-Technologie bündelte Konten und automatisierte die Diversifikation von Einlagen zur Risikominimierung. Das Modell erregte schnell Aufmerksamkeit und führte bereits im Sommer 2024 zu einem frühen Exit: Die 2019 gegründete Berliner Neobank Vivid Money übernahm das Start-up, um das eigene Business-Banking-Angebot mit Piles Treasury-Technologie aufzurüsten – ein Paradebeispiel für die rasante Konsolidierung im FinTech-Infrastrukturmarkt.

Internationaler Ausblick & Fazit

Blickt man über die Grenzen Europas hinaus, formen sich 2026 drei gewaltige Makro-Trends, die den deutschen Markt unausweichlich verändern werden. Aus Asien schwappt die Architektur für grenzüberschreitende Echtzeit-Settlements basierend auf regulierten Stablecoins und digitalen Zentralbankwährungen heran, was das traditionelle Korrespondenzbankensystem massiv unter Druck setzt. Die USA hingegen dominieren die Entwicklung der KI-gesteuerten autonomen Finanzen, bei der das Corporate Treasury von Algorithmen gesteuert wird, die ohne menschliches Zutun Liquidität verschieben. Aus Indien lernen wir, wie Identity-as-a-Service untrennbar mit dem Zahlungsverkehr verschmilzt und Betrug nahezu ausmerzt.

Für Gründer*innen und Investor*innen im DACH-Raum bedeutet dies: Der Fokus muss radikal auf Profitabilität, wasserdichter Compliance und extrem stabiler Infrastruktur liegen. Wer heute in Embedded Finance gewinnt, baut keine bunten Apps mehr, sondern die hochkomplexen, unsichtbaren Stahlträger der digitalen Weltwirtschaft.

Boschs 200-Mio.-Euro-Wette: Kann der Industrieriese wirklich Start-up?

Bosch pumpt frische Millionen in seinen hauseigenen Venture Builder. Während andere Konzerne ihre Inkubatoren dichtmachen, will der Stuttgarter Hardware-Gigant externe Gründer*innen anlocken und tiefe Tech-Innovationen ausgründen. Ein vielversprechendes Modell für DeepTech-Start-ups – oder eine strategische Sackgasse?

Bosch Business Innovations, der Corporate Venture Builder der Bosch Gruppe, investiert in den kommenden fünf Jahren rund 200 Millionen Euro in den Aufbau neuer DeepTech-Ventures. Das ehrgeizige Ziel: Bis 2030 sollen 20 neue Start-ups außerhalb des Bosch-Kerngeschäfts aufgebaut und zur Marktreife geführt werden. Doch die Ankündigung fällt in eine Zeit, in der das Modell Corporate Venture Building (CVB) in Europa in einer tiefen Krise steckt. Konzern-Inkubatoren von SAP, Allianz oder ProSiebenSat.1 haben in der Vergangenheit längst die Segel gestrichen. Warum glaubt Bosch, die Ausnahme von der Regel zu sein?

DeepTech trifft auf Konzern-Ressourcen

Im Gegensatz zur reinen Investment-Tochter Bosch Ventures (Robert Bosch Venture Capital), die als klassischer Geldgeberin agiert, will Bosch Business Innovations Unternehmen von Grund auf selbst bauen. Zum Start konzentriert sich die Einheit auf drei hochkomplexe Bereiche: medizinische Fernüberwachung, softwaregesteuerte Fertigung und Carbon Capture.

Der Pitch an die Szene klingt verlockend: Bosch verschafft Gründungsteams einen kuratierten Zugang zu Patenten, Forschung, Testlaboren, Ingenieurwissen und globalen Lieferketten. Im Bereich Carbon Capture will man beispielsweise direkt auf bestehende Patente und technologische Vorarbeiten des Konzerns aufsetzen. Externe Gründerinnen und Gründer sollen dabei frühzeitig Verantwortung übernehmen und die Unternehmen von Anfang an aufbauen. Axel Deniz, Geschäftsführer von Bosch Business Innovations, formuliert es so: Man wolle die Technologie und die industrielle Stärke von Bosch mit der Geschwindigkeit und dem unternehmerischen Denken der Start-up-Welt verbinden.

Gegen den „CVB-Winter“

Dass Bosch genau jetzt diese Summen lockermacht, ist ein starkes Signal gegen den aktuellen „CVB-Winter“. Viele Konzern-Inkubatoren scheitern traditionell an der mangelnden Geduld des Mutterkonzerns, quälend langsamen Freigabeprozessen oder einer zu engen inhaltlichen Fesselung an das Bestandsgeschäft.

Bosch versucht, diese strukturellen Fehler zu umgehen, indem der Fokus explizit auf neuen Märkten jenseits des Kerngeschäfts liegt. Zudem öffnet sich die Einheit gezielt für die Außenwelt: Die Zusammenarbeit mit externen Venture Studios und Investor*innen soll den Zugang zu Ökosystemen verbessern und vor allem zusätzliches Kapital mobilisieren. Die Ventures sollen bis zur Investment Readiness begleitet werden und setzen dabei auf Co-Investments. Dass dieser Spin-off-Ansatz Früchte tragen kann, zeigte unlängst der erfolgreiche Exit des Corporate-Start-ups Bosch Advanced Ceramics, das aus dem Bosch-Inkubator hervorging und zum Jahreswechsel 2025/2026 an den japanischen Anlagenbauer Sintokogio verkauft wurde.

Wo liegt der Haken für Gründer*innen?

Trotz dieser Erfolge hat das Modell Tücken, die man kritisch prüfen muss. Die zentrale Frage für externe Gründer*innen lautet: Wie unabhängig kann ein Start-up wirklich agieren, wenn der entscheidende IP-Zugang (Patente, Technologie) vom Mutterkonzern kontrolliert wird?

- Geschwindigkeit vs. Konzernstruktur: Start-ups brauchen Agilität und Pivot-Bereitschaft. Konzerne hingegen neigen dazu, sich durch Vetorechte oder strategische Kontrollmechanismen abzusichern. Es besteht immer die Gefahr, dass der Corporate-Partner eher als Bremse denn als Beschleuniger wirkt.

- Die Cap-Table-Falle: Wenn Bosch das Initialkapital stellt, die Patente einbringt und die Infrastruktur liefert, bleibt für externe Gründungsteams oft nur ein Bruchteil der Anteile. Eine „schiefe“ Cap Table (Kapitalverteilung) kann jedoch spätere VC-Runden massiv erschweren, da externe Investor*innen motivierte Gründer*innen mit signifikanten Anteilen sehen wollen.

- IP-Rechte: Wem gehört die Technologie, wenn das Start-up scheitert oder sich vom Konzern lösen will? Ohne saubere und gründungsfreundliche IP-Transfer-Bedingungen wird jedes Venture zum Gefangenen seines Inkubators.

Unser Fazit: Ein Deal für Heavy-Tech, nicht für Software-Shootingstars

Für Gründer*innen im B2C- oder reinen Software-SaaS-Bereich ist das Angebot von Bosch Business Innovations uninteressant; hier genügen klassische VCs und die eigene Agilität. Wer jedoch im DeepTech-Sektor gründen will – sei es in der industriellen Dekarbonisierung oder der Medizintechnik –, steht oft vor einem enormen Hardware- und Kapital-Bottleneck. Die Entwicklungskosten sind hier astronomisch hoch.

In genau diesen „Hard Tech2-Feldern kann das Angebot von Bosch ein echter Katalysator sein. Der Zugang zu einer der weltweit größten Patentbibliotheken und industrieller Skalierung senkt das Technologierisiko enorm.

Das 200-Millionen-Euro-Commitment ist ein wichtiges Bekenntnis zum DeepTech-Standort Deutschland. Wer als Gründungsteam einsteigt, sollte sich jedoch nicht von den großen Ressourcen blenden lassen, sondern vorab knallhart über Anteile, operative Eigenständigkeit und IP-Rechte verhandeln. Nur wenn Bosch den Gründer*innen echte Beinfreiheit lässt, entstehen hier bis 2030 tatsächlich 20 flugfähige Start-ups – und nicht nur teure, konzerninterne Forschungsprojekte.

Vom Notfallknopf zum KI-Begleiter: Patronus sammelt 11 Mio. Euro ein

Das 2020 von Ben Staudt und Tim Wagner gegründete Berliner Start-up Patronus sichert sich eine weitere Mio.-Finanzierungsspritze für seinen digitalen (Notruf-)Assistenten im Smartwatch-Format. Doch im stark umkämpften Senior*innen-Tech-Markt reicht ein schickes Design allein nicht mehr aus. Ein Blick hinter die Kulissen von Geschäftsmodell, Historie und wachsendem Wettbewerb.

Die Idee zu Patronus entstand aus einem klassischen Alltagsproblem, das viele Familien kennen: Gründer Ben Staudt erlebte bei seiner eigenen Großmutter, dass der traditionelle, klobige Hausnotrufknopf statt um den Hals zu hängen, lediglich als „Nachttischdekoration“ fungierte. Gemeinsam mit Mitgründer Tim Wagner rief er daraufhin im Jahr 2020 das Unternehmen in Berlin ins Leben. Vor der Veröffentlichung ihres ersten Produkts im Jahr 2021 führte das Team nach eigenen Angaben über tausend Gespräche mit potenziellen Nutzer*innen. Die zentrale Erkenntnis: Die Ablehnung herkömmlicher Notrufsysteme ist weniger technischer Natur, sondern vielmehr ein Problem der Würde und Stigmatisierung.

Mittlerweile ist das Team auf 70 Mitarbeitende angewachsen. Nachdem das Start-up in der Vergangenheit bereits eine beachtliche 27-Millionen-Euro-Runde abschließen konnte, fließen nun weitere 11 Millionen Euro Wachstumskapital in das Unternehmen. Bei dieser Runde wird das Konsortium von 3TS Capital Partners angeführt. Begleitet wird die Finanzierung von Grazia Equity sowie Bestandsinvestoren wie Singular, Burda Principal Investments, Adjacent, NAP und UVC Partners.

Das Produkt: Hohe Akzeptanz trifft auf KI-Visionen

Das Kernprodukt von Patronus ist eine Smartwatch, die sich optisch bewusst von klassischer Medizintechnik abhebt, verschiedene Farben bietet und wie eine herkömmliche Armbanduhr wirkt. Ausgestattet mit einer integrierten SIM-Karte stellt sie im Notfall auf Knopfdruck eine sofortige Verbindung zu einer hauseigenen, mit Fachpersonal besetzten 24/7-Notrufzentrale her.

Der nutzer*innenzentrierte Ansatz zeigt laut Unternehmenszahlen deutliche Wirkung:

- Während klassische Hausnotrufgeräte laut Studien nur von 14 Prozent der Nutzer*innen durchgehend getragen werden.

- Liegt die tägliche Tragequote der Patronus-Uhr bei 85 Prozent.

- Mittlerweile verzeichnet das Start-up 25.000 aktive Kund*innen.

- Die hauseigene Zentrale hat für diese Nutzer*innen bereits mehr als eine halbe Million Notrufe beantwortet.

- Parallel dazu verbindet eine eigens entwickelte App 50.000 Angehörige mit den Senior*innen, um deren Status – wie den Standort oder ob die Uhr getragen wird – im Blick zu behalten.

Das frische Kapital fließt nun in den weiteren Ausbau der Marktführerschaft im mobilen Notrufsegment sowie in einen neuen Produktbereich: einen KI-Begleiter. Dieser soll als digitaler Assistent direkt am Handgelenk über die Patronus Uhr verfügbar sein. Da 12 Prozent der über 75-Jährigen in Deutschland an einem durchschnittlichen Tag kein einziges persönliches Gespräch führen, soll der Assistent dem Gefühl der Einsamkeit in stillen Stunden entgegenwirken.

Geschäftsmodell, Markt & Wettbewerb

So glänzend die Zahlen der Pressemitteilung wirken, verlangt das Geschäftsmodell im dynamischen AgeTech-Sektor eine differenzierte Betrachtung:

Der demografische Rückenwind: Der Bedarf an digitalen Lösungen für ältere Menschen wächst rasant. In Deutschland leben heute 9,6 Millionen Menschen im Alter von über 75 Jahren, in ganz Europa sind es 47,4 Millionen. Gleichzeitig nimmt die Zahl der pflegenden Angehörigen ab. Ein immer größerer Anteil will allein leben. Laut Destatis leben in Deutschland bereits 43 Prozent der Menschen über 75 Jahre allein.

Abo-Modell und Kassen-Abhängigkeit: Patronus refinanziert sich maßgeblich über ein Abo-Modell. Ein wesentlicher Wachstumstreiber ist dabei der deutsche Gesundheitsmarkt: Bei Vorliegen eines Pflegegrads kann die Pflegekasse die monatlichen Nutzungsgebühren (die Software, SIM-Karte und Leitstelle abdecken) stark bezuschussen. Ohne diese staatlichen Subventionen hätten viele Senioren Schwierigkeiten, die fortlaufenden Service-Kosten zu tragen. Diese Abhängigkeit von gesundheitspolitischen Rahmenbedingungen bleibt ein strukturelles Risiko.

Der harte Hardware-Wettbewerb: Patronus positioniert sich als digitaler Marktführer im mobilen Notrufsegment in Deutschland. Doch die Konkurrenz holt auf. Dedizierte Senior*innen-Smartwatches anderer Anbieter*innen bieten ebenfalls moderne Designs, SIM-Karten, Notruf-Sprachverbindungen und teils automatische Sturzerkennungen an. Zudem dringen Tech-Giganten tief in den Markt ein: Apple Watches verfügen längst über präzise Sturzerkennungen und EKG-Funktionen und werden zunehmend von technikaffinen "Best Agern" adaptiert. Der langfristige Burggraben von Patronus muss daher zwingend in der nahtlosen, stark vereinfachten Software-Integration und der menschlichen Notrufzentrale liegen – die Hardware allein ist auf Dauer austauschbar.

Das ethische Dilemma der KI: Einsamkeit unter älteren Menschen ist ein anerkanntes Gesundheitsrisiko, das die kognitive Leistungsfähigkeit beeinflussen, das Demenzrisiko erhöhen und die Lebenserwartung verkürzen kann. Die Lösung von Patronus, diesem Problem mit einem KI-Begleiter zu begegnen, ist innovativ, aber ethisch sensibel. Altersforscher warnen davor, dass "künstliche" Gespräche den Drang nach echten sozialen Interaktionen mindern könnten. Dass Patronus selbst betont, der KI-Begleiter solle menschliche Nähe nicht ersetzen, sondern nur eine Antwort für Stunden bieten, in denen niemand da ist, ist ein wichtiger Disclaimer. Dennoch muss das Unternehmen in der Praxis beweisen, dass die KI im sensiblen Pflegeumfeld echte Empathie simulieren kann, ohne die Nutzer*innen zu verwirren.

Unser Fazit

Patronus zeigt, wie man durch konsequentes User-Centric-Design einen verstaubten Markt aufbricht und stigmatisierte Produkte salonfähig macht. Die neuen 11 Millionen Euro geben dem Start-up den nötigen Spielraum für technologische Innovationen. Um die hohe Bewertung nachhaltig zu rechtfertigen, muss Patronus künftig jedoch beweisen, dass der Vorstoß in die künstliche Intelligenz ethisch sauber umgesetzt wird und man dem zunehmenden Hardware-Preisdruck der Wettbewerber*innen standhalten kann.

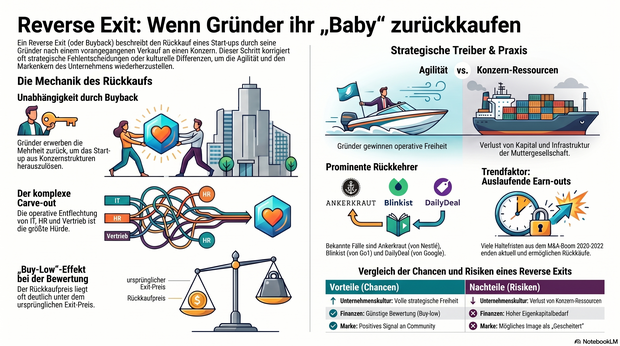

Reverse Exit: Wenn der Exit den Rückwärtsgang einlegt

In jüngster Zeit häufen sich in der Start-up-Szene Fälle, in denen Gründer*innen ihr Lebenswerk nach einem Exit überraschend zurückkaufen. Wir zeigen, was es mit dem Reverse Exit auf sich hat.

Für die meisten Gründer*innen ist er das ultimative Ziel auf der Start-up-Reise: der Exit. Doch was passiert, wenn die Traumhochzeit mit dem Konzern oder dem/der Großinvestor*in im Alltagstresor der Konzernstrukturen erstickt? Der sogenannte Reverse Exit rückt in den Fokus – und wirft für angehende wie gestandene Gründer*innen die Frage auf, ob ein Verkauf wirklich immer das Ende der eigenen Unternehmensgeschichte sein muss.

Was ist ein Reverse Exit?

Ein Reverse Exit (oft auch als Buyback oder Management Buyout / MBO nach einem vorherigen Verkauf bezeichnet) beschreibt den Vorgang, bei dem die ursprünglichen Gründer*innen oder das Managementteam die Mehrheit oder alle Anteile ihres Start-ups von dem/der bisherigen Käufer*in zurückerwerben. Das Start-up wird dadurch aus den Strukturen des Konzerns oder der Investor*innengruppe herausgelöst und agiert wieder als eigenständiges, unabhängiges Unternehmen.

Motivation der Beteiligten: Warum die Rolle rückwärts?

Ein Reverse Exit geschieht selten aus einer Laune heraus. Er ist zumeist das Ergebnis eines Reifeprozesses, bei dem beide Seiten erkennen, dass getrennte Wege wirtschaftlich und strategisch sinnvoller sind.

- Motivation der Gründer*innen (Käufer*innen): Oft prallen nach einem Exit die agile Start-up-Kultur und starre Konzernprozesse schmerzhaft aufeinander. Gründer*innen wollen die operative Entscheidungsgewalt zurückerlangen, eine verwässerte Markenidentität retten oder das Unternehmen schnell auf neue Markttrends (wie aktuell künstliche Intelligenz) ausrichten, was im Konzerngeflecht schlicht zu lange dauern würde.

- Motivation der Corporates (Verkäufer*innen): Konzerne trennen sich meist wieder von ihren Zukäufen, wenn das Start-up die erhofften Synergien nicht bringt oder die Umsätze nach der Übernahme stagnieren. Manchmal ändern sich auch die strategischen Kernziele des Mutterkonzerns, sodass das Start-up als „Non-Core-Asset“ wieder abgestoßen wird.

Vor- und Nachteile eines Reverse Exits

Der Rückkauf des eigenen „Babys“ mag romantisch klingen, ist wirtschaftlich aber ein enormer Kraftakt. Die wichtigsten Aspekte im Überblick:

Aspekt | Vorteile (Chancen) | Nachteile (Risiken) |

Unternehmenskultur | Volle strategische Freiheit und Rückbesinnung auf den ursprünglichen Markenkern | Verlust der Konzern-Ressourcen (Kapital, Vertriebsnetzwerk, Infrastruktur) |

Finanzen | Chance auf eine günstige Unternehmensbewertung beim Rückkauf (Buy-low-Effekt) | Hoher Kapitalbedarf für den Erwerb und das anschließende operative Geschäft |

Image & Marke | Starkes, positives Signal an die Community und Mitarbeiter („Wir sind wieder da“) | Reputationsrisiko bei künftigen B2B-Partner*innen, möglicher „Gescheitert“-Stempel |

Neben diesen offensichtlichen Punkten gibt es weitere, tieferliegende Schmerzpunkte, die bei einem Buyback zwingend auf dem Schirm sein müssen:

- B2B-Kund*innen und „Change of Control“-Klauseln: Große Enterprise-Kund*innen arbeiten oft gern mit Start-ups zusammen, weil im Hintergrund ein bonitätsstarker Konzern steht. Fällt dieses Sicherheitsnetz weg, greifen in Verträgen oft sogenannte Change of Control-Klauseln. Diese räumen den Kun*innen ein Sonderkündigungsrecht ein, weshalb wichtige Großkund*innen oft mühsam neu verhandelt werden müssen.

- Die Mitarbeitendenperspektive & ESOPs: Bei einem Exit werden Mitarbeitendenbeteiligungsprogramme (ESOPs/VSOPs) oft ausbezahlt und verfallen danach. Beim Rückkauf fängt das Start-up in Sachen Mitarbeitenden-Incentivierung oft wieder bei null an. Zudem bedeutet der Wegfall der Konzernstrukturen für manche Mitarbeitenden einen Verlust an Sicherheit (z.B. keine Konzern-Boni mehr), was den Buyback zu einem massiven HR-Kraftakt macht.

- Wem gehört das IP? (Geistiges Eigentum): Die Herauslösung von Patenten, Code oder Markenrechten, die während der Konzernzugehörigkeit entwickelt wurden, ist ein rechtliches Schlachtfeld. Gründer*innen müssen absichern, dass sie wirklich die uneingeschränkten Rechte an ihrem eigenen Produkt zurückkaufen.

Wie geht ein Reverse Exit vonstatten?

Der Prozess eines Rückkaufs ist oft deutlich komplizierter als der ursprüngliche Exit, da das Start.up bereits administrativ in den Konzern integriert wurde. Ein typischer Ablauf vollzieht sich in vier Schritten:

- Initiierung und Sondierung: Zumeist nach strategischen Differenzen oder Umstrukturierungen im Konzern treten die Gründer*innen mit einem Übernahmeangebot an den Eigentümer*innen heran.

- Unternehmensbewertung: Eine neue Due Diligence ist notwendig. Da das Wachstum im Konzern oft stagnierte oder Markenwerte gelitten haben, liegt der Kaufpreis häufig deutlich unter der damaligen Exit-Bewertung.

- Finanzierung: Die Gründer*innen müssen das Kapital aufbringen. Dies geschieht in der Regel durch das persönliche Vermögen aus dem ersten Exit, klassische Bankkredite oder die Hereinnahme spezialisierter Private-Equity-Partner*innen. Hier lauern zudem steuerliche Fallstricke: Der Rückkauf muss klug strukturiert werden (z.B. über eine Holding), um keine unnötigen steuerlichen Belastungen wie verdeckte Gewinnausschüttungen oder ungünstige Bewertungen durch das Finanzamt auszulösen.

- Carve-out (Herauslösung): Das ist die größte operative Hürde. IT-Systeme, HR-Prozesse, Buchhaltung und Vertriebslinien, die teilweise über Jahre mit dem Konzern verschmolzen wurden, müssen entflochten und eigenständig neu aufgebaut werden.

Reverse Exits in der Praxis: Von historischen Blueprints zu aktuellen Paukenschlägen

Dass der Reverse Exit kein reines Theoriekonstrukt ist, beweisen zahlreiche Beispiele aus der DACH-Region. Er ist keine völlige Neuerscheinung, sondern hat sich über die Jahre als strategisches Werkzeug etabliert:

Die historischen und B2B-Blaupausen

- DailyDeal (Exit: 2011 / Rückkauf: 2013): Die „Mutter aller Reverse Exits“ in Deutschland. Die Brüder Fabian und Ferry Heilemann verkauften ihr Gutschein-Portal 2011 für über 100 Millionen Dollar an Google. Als der Konzern das Interesse am kleinteiligen europäischen Markt verlor, kauften sie es 2013 für einen Bruchteil zurück, sanierten es und verkauften es 2015 ein zweites Mal erfolgreich.

- Holvi (Exit: 2016 / Rückkauf: 2021): Das finnisch-deutsche Business-Banking-Fintech wurde 2016 von der spanischen Großbank BBVA übernommen. Als sich die Bank strategisch neu aufstellte, kaufte Gründer Tuomas Toivonen sein Start-up 2021 zurück, um die Produktstrategie wieder agil und ohne bankenübliche Compliance-Bremsen zu steuern.

- FastBill (Exit: 2021 / Rückkauf: 2024): Die Frankfurter Buchhaltungs-Pioniere verkauften an den kanadischen Konkurrenten FreshBooks. Nach internen Umstrukturierungen des Käufers und dessen Rückzug aus Europa zogen die FastBill-Gründer René Maudrich und Benjamin Kirschner einen Management Buyout durch und operieren seither wieder eigenständig und profitabel.

Aktuelle Schlagzeilen im April 2026

Zuletzt sorgten zudem hochkarätige B2C-Fälle für großes Aufsehen in den Wirtschaftsmedien: