Aktuelle Events

Frauen investieren anders, oft erfolgreicher

Studien belegen das geschlechtsspezifischen Investitionsgefälle und zeigen, dass Frauen als Investorinnen dennoch oftmals die Nase vorn haben.

Investitionen waren lange Zeit ein von Männern dominierter Bereich. Das hat vor allem historische Gründe wie bspw. rechtliche Hindernisse, die früher den Zugang von Frauen zu Finanzdienstleistungen einschränkten, oder áuch kulturelle Normen, die Männer als die Entscheider in Finanzangelegenheiten ansahen. Hinzu kommt das geschlechtsspezifische Einkommensgefälle, das die Investitionsmöglichkeiten von Frauen einschränkte und zum Teil auch heute noch einschränkt. Auch wenn es inzwischen Fortschritte gibt, wirken diese Hindernisse bis heute nach und tragen zum geschlechtsspezifischen Investitionsgefälle bei.

Die sich wandelnde Landschaft

Trotz dieser historischen Hürden machen Frauen bedeutende Fortschritte. In den USA hat eine Fidelity-Studie herausgefunden, dass 67 Prozent der Frauen heute außerhalb von Rentenkonten investieren, im Vergleich zu 44 Prozent im Jahr 2018. Zudem hat eine BlackRock-Umfrage 2024 gezeigt, dass die Zahl der Anlegerinnen in Europa seit 2022 um 11 Prozent gestiegen ist.

Noch überzeugender ist, dass Frauen, wenn sie investieren, oft gut abschneiden. Nach Angaben von Revolut übertrafen Frauen ihre männlichen Kollegen bei der Investitionsrentabilität im Jahr 2024 um 4 Prozent, da sie effektivere Investitionsentscheidungen trafen.

Frauen zeigen bei ihren Investitionen positive Eigenschaften, die langfristiges Wachstum fördern. Nach Angaben der DWS neigen sie dazu, einen strategischen, langfristigen Ansatz zu verfolgen, bei dem finanzielle Sicherheit und Stabilität Vorrang vor kurzfristigen Gewinnen haben. Dies führt zu einer disziplinierten Entscheidungsfindung und einer Vorliebe für diversifizierte Anlageformen wie ETFs. Frauen sind auch widerstandsfähiger und geduldiger bei Marktschwankungen und neigen im Vergleich zu Männern weniger dazu, Anlagen mit Verlust zu verkaufen.

Was steht Frauen im Weg?

Trotz der jüngsten Fortschritte stehen Frauen bei der Verwirklichung der finanziellen Gleichstellung immer noch vor großen Herausforderungen. Das geschlechtsspezifische Einkommensgefälle ist ein wichtiger Faktor, der durch geringere Einkünfte, eine geringere Investitionsbeteiligung und Unterbrechungen der beruflichen Laufbahn für die Familienplanung geprägt ist. Dies schränkt die Investitionsmöglichkeiten von Frauen ein und vergrößert die Vermögenslücke. Im Rentenalter haben Männer in einigen Ländern im Durchschnitt 42 Prozent mehr Vermögen als Frauen.

Auch das Selbstvertrauen spielt eine entscheidende Rolle, denn nur ein Drittel der Frauen fühlt sich einer Investitionstätigkeit gewachsen. Diese Diskrepanz ist jedoch größtenteils darauf zurückzuführen, dass sie ihr Wissen unterschätzen. In Studien antworteten Frauen häufiger mit "Ich weiß es nicht", aber als diese Option gestrichen wurde, stiegen ihre richtigen Antworten um 14 Prozent. Dies zeigt, dass nicht mangelndes Wissen, sondern Zögern das Haupthindernis darstellt. Dieser Vertrauensmangel wird noch verstärkt durch Darstellungen der Medien, in denen Frauen als weniger sachkundig oder zweitrangig dargestellt werden. Das verstärkt die Vorstellung, dass Investitionen nichts für Frauen sind, und befeuert das geschlechtsspezifische Investitionsgefälle.

Hinzu kommt, dass Finanzdienstleistungen, -produkte und -kurse oft nicht auf die Bedürfnisse von Frauen zugeschnitten sind und sich das Marketing und die Sprache in der Regel an ein männliches Publikum richten. Studien zeigen, dass sich 67 Prozent der Frauen vom Finanzdienstleistungssektor nicht verstanden oder nicht berücksichtigt fühlen, was ebenfalls zu diesem Problem beitragen kann.

Wie können Finanzunternehmen helfen?

Um diese Herausforderungen zu bewältigen, bedarf es konkreter Maßnahmen, die Investitionen integrativer und zugänglicher machen. „Es ist von entscheidender Bedeutung, dass wir die Vorstellung entmystifizieren, dass Investitionen nur etwas für Wohlhabende oder finanziell Erfahrene sind”, so Martins Sulte, CEO und Mitgründer von Mintos. „Zum Investieren braucht man keine großen Geldsummen. Jede(r) kann mit kleinen, überschaubaren Beträgen beginnen, insbesondere bei einfachen Anlagen wie ETFs, mit denen man nach und nach lernen und Finanzwissen aufbauen kann.”

Er fährt fort: „Ein weiterer Schlüsselfaktor ist es, das Vertrauen zu stärken. Die Branche muss dafür sorgen, dass die Finanzinstrumente für alle zugänglich und ansprechend sind. Wir müssen uns darauf konzentrieren, benutzer*innenfreundliche Apps und Plattformen zu entwickeln, die sich an unterschiedliche Anleger*innen richten und sicherstellen, dass sich alle mit diesen Werkzeugen wohlfühlen.”

Diese Artikel könnten Sie auch interessieren:

ENVIOTECH sichert sich Millionenfinanzierung für intelligente öffentliche Straßenbeleuchtung

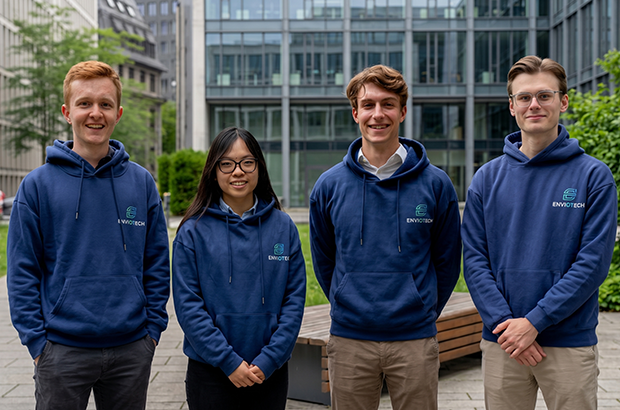

Das Frankfurter Start-up ENVIOTECH rund um Adrian Rhaese, Linh Pham, Dustin Arnold und Peter Kletsko hat eine Pre-Seed-Runde in Höhe von einer Million Euro abgeschlossen, um öffentliche Straßenbeleuchtung intelligent nachzurüsten. Doch der Markt für kommunale Infrastruktur ist hart umkämpft und bürokratisch. Kann das junge Team die öffentlichen Verwaltungen überzeugen?

Es ist ein klassisches Gründer*innen-Narrativ: Aus einem persönlichen Schmerzpunkt entsteht eine Geschäftsidee. Im Fall von ENVIOTECH war es ein Fahrradunfall. Der beste Freund von Mitgründer Adrian Rhaese verunglückte, weil in einer deutschen Stadt die Straßenlaternen aufgrund gestiegener Stromkosten abgeschaltet worden waren. Dieser Vorfall weckte bei Rhaese das Unverständnis darüber, dass in einem wirtschaftlich starken Land ausgerechnet an der Sicherheit gespart wird – und legte den Grundstein für das Smart-City-Start-up.

Bye-bye Bankenturm: Der Sprung ins kalte Wasser

Anstatt ihren als sicher geltenden Karriereweg fortzusetzen, verließen Adrian Rhaese und Mitgründerin Linh Pham ihre Positionen als duale Studierende bei der Deutschen Bank. Sie entschieden sich bewusst für das unternehmerische Risiko, um reale Infrastrukturprobleme zu lösen.

Eine erste Bestätigung für diesen Schritt erhielt das junge Team durch die Aufnahme in das EWOR Fellowship. Daniel Dippold, Gründer und CEO von EWOR, bescheinigt dem Team den richtigen Fokus: „Unspektakuläre Infrastruktur gewinnt langfristig fast immer. Straßenbeleuchtung ist nicht glamourös, aber sie ist allgegenwärtig, unverzichtbar und aus keiner Stadt wegzudenken.“

Plug-and-Play am Lichtmast: Das 15-Minuten-Update

Die technische Lösung von ENVIOTECH setzt auf Pragmatismus: Anstatt Laternen kostenintensiv komplett auszutauschen, bietet das Unternehmen ein Retrofit-System an. Das Produkt soll sich laut Unternehmensangaben in unter 15 Minuten in bestehende Leuchten integrieren lassen.

Die nachgerüsteten Laternen kommunizieren als Mesh-Netzwerk miteinander und dimmen das Licht KI-gesteuert und bedarfsgerecht anhand von Bewegungserkennung. Das Startup verspricht dadurch Energieeinsparungen von bis zu 80 Prozent; gleichzeitig soll die öffentliche Sicherheit erhöht werden. Kommunen erhalten so die Möglichkeit, ihre Beleuchtung zentral zu steuern und in Echtzeit zu überwachen.

Um das Konzept in die Fläche zu tragen, konnte ENVIOTECH nun eine Pre-Seed-Finanzierung in Höhe von 1 Million Euro einsammeln. Angeführt wird die Runde passenderweise vom ehemaligen Co-CEO der Deutschen Bank, Jürgen Fitschen. Ergänzt wird das Konsortium durch Ex-MAN-CEO Joachim Drees, Alexander Eyhorn (Gründer von Bidirex) und Danilo Jovicic-Albrecht (Mitgründer des auf Kommunen spezialisierten Startups Vialytics). Mit dem frischen Kapital sollen Pilotprojekte forciert und das Technologieportfolio weiterentwickelt werden.

Der Endgegner heißt B2G-Markt: David gegen die Industrie-Goliaths

So einleuchtend die Technologie klingt, das Geschäftsmodell von ENVIOTECH steht vor gewaltigen Hürden. Der B2G-Markt (Business-to-Government) ist für Start-ups extrem schwierig. Kommunen, die ENVIOTECHs primäre Zielgruppe darstellen, arbeiten mit langen Budgetzyklen und streng regulierten öffentlichen Ausschreibungsverfahren. Bis ein Pilotprojekt zu einem flächendeckenden Rollout führt, vergehen oft Jahre.

Darüber hinaus agiert das Start-up nicht im luftleeren Raum. Der Smart-Lighting-Markt wird von Industriegiganten wie Signify oder Schréder dominiert, die längst eigene IoT-Lichtsteuerungssysteme anbieten. Auch andere Start-ups wie Tvilight oder Icegateway haben das Potenzial vernetzter Straßenbeleuchtung erkannt.

Der entscheidende USP von ENVIOTECH muss daher in der Geschwindigkeit und Einfachheit liegen: Gelingt die versprochene rasante Installation und können Kommunen die Lösung ohne massive Tiefbauarbeiten testen, hat das Start-up einen echten Wettbewerbsvorteil. Besonders klug ist hierbei die Auswahl der Investor*innen: Mit Drees und Jovicic-Albrecht hat das Gründerduo Köpfe an Bord geholt, die wissen, wie man komplexe Produkte an die öffentliche Hand verkauft. Schafft es ENVIOTECH, den extrem zähen Vertriebszyklus öffentlicher Verwaltungen zu knacken, könnte das Unternehmen zu einem hochrentablen Hidden Champion heranwachsen.

Primogene: 4,1 Mio. Euro für den Muttermilch-Code – Deep-Tech-Innovation oder riskantes Unterfangen?

Das Leipziger BioTech-Start-up Primogene hat eine Seed-Finanzierung in Höhe von 4,1 Mio. Euro eingesammelt, um komplexe bioaktive Moleküle im industriellen Maßstab auf den Markt zu bringen.

Während die Unternehmenskommunikation den Durchbruch einer neuen Plattformtechnologie feiert, zeigt ein genauerer Blick auf den globalen Markt für humane Milcholigosaccharide (HMOs) ein Haifischbecken voller multinationaler Konzerne. Eine kritische Analyse des Geschäftsmodells, der Gründer*innen und des Wettbewerbs.

DeepTech Made in Leipzig

Hinter Primogene stehen Dr.-Ing. Reza Mahour (CEO), Valerian Grote und Linda Karger (COO), die das Unternehmen 2023 in Leipzig gründeten. Die Zusammensetzung des Teams vereint technologische und wissenschaftliche Expertise, um die ehrgeizige Vision einer industriellen Enzym-Produktion umzusetzen. Die aktuelle, 4,1 Millionen Euro starke Seed-Runde wird vom High-Tech Gründerfonds (HTGF) angeführt. Zum Investoren-Konsortium gehören außerdem der Technologiegründerfonds Sachsen (TGFS), better ventures, die Sächsische Beteiligungsgesellschaft (SBG), die Golzern Holding GmbH, die FS Life Science Investment GmbH sowie Dr. Marc Struhalla, Gründer und CEO der c-LEcta GmbH. Der Kapitaleinsatz ist klar definiert: Die neuen Mittel fließen in den Ausbau des IP-Portfolios, die Erweiterung der Produktionskapazitäten in Leipzig und in strategische Partnerschaften.

Das Modell im Stresstest: Die Kostenfalle der Enzyme

Primogene hat eine enzymatische Plattformtechnologie entwickelt, um Inhaltsstoffe zu produzieren, die identisch zu natürlichen Molekülen sind – nachhaltig und kosteneffizient. Im Zentrum stehen dabei komplexe humane Milcholigosaccharide (HMOs) wie Disialyllacto-N-Tetraose (DSLNT) und Difucosyllacto-N-Tetraose I (LNDFH I). Laut Primogene verursachen etablierte fermentative Herstellungsverfahren erhebliche Kosten und stoßen bei der Produktion derartiger hochkomplexer Moleküle an ihre Grenzen.

Der Lackmustest: Die Prämisse, dass enzymatische Verfahren in der Massenproduktion überlegen sind, birgt in der Praxis massive Hürden. Die Entwicklung und wirtschaftliche Produktion der benötigten Enzyme selbst ist extrem kapitalintensiv. Dass das Start-up den gesamten Prozess – von der Enzymentwicklung über die Produktion und Biotransformation bis zur Aufreinigung – komplett am eigenen Unternehmensstandort in Leipzig abbilden will, ist ein ambitionierter, aber riskanter Schritt. Der Aufbau eigener Produktionsanlagen für komplexe BioTech-Prozesse führt oft zu einer enorm hohen Kapitalverbrennungsrate (Burn Rate).

Erste kommerzielle Meilensteine dämpfen dieses Risiko jedoch: Erste Inhaltsstoffe für Kosmetikprodukte wurden mit Kooperationspartnern entwickelt und sind bereits kommerziell erhältlich. Auch pharmazeutische Rohstoffe befinden sich aktuell im Test bei Kund*innen. Zudem erforscht das Unternehmen in Zusammenarbeit mit dem Fraunhofer-Institut für Zelltherapie und Immunologie (IZI) in Leipzig das Potenzial seiner Inhaltsstoffe zur Prävention von Infektionskrankheiten.

Im Haifischbecken: Auf Kollisionskurs mit den Lebensmittel-Riesen

Der Zielmarkt ist hochattraktiv: Der globale HMO-Markt wächst jährlich um etwa 18 bis 20 Prozent, und über 65 Prozent der im Jahr 2023 neu eingeführten Säuglingsnahrungsprodukte enthielten mindestens ein HMO. Neben der Säuglingsernährung bedient Primogene auch Märkte wie die Darmgesundheit bei Erwachsenen, die Gedächtnisverbesserung im Alter sowie funktionale Inhaltsstoffe für Körperpflege und pharmazeutische Rohstoffe.

Das Leipziger Team trifft in der Nahrungsmittelindustrie jedoch auf einen extrem konsolidierten Markt, der von Milliarden-Konzernen dominiert wird. Einer der größten B2B-Zulieferer für Säuglingsnahrung weltweit ist DSM-Firmenich (mit der übernommenen Sparte Glycom), der den Markt durch gigantische Größenvorteile (Economies of Scale) in der Fermentation beherrscht. Auch Chr. Hansen (Jennewein), ein Pionier in der mikrobiellen HMO-Synthese, stellt mit seiner extrem tiefen Integration bei Lebensmittelriesen einen massiven Konkurrenten dar. Auf der Abnehmerseite agieren Endkonsument*innen-Giganten und Branchenführer wie Nestlé und Abbott, bei denen für einen neuen Zulieferer von Inhaltsstoffen extrem hohe regulatorische und volumenbasierte Hürden bestehen.

Primogenes strategische Nische: Ein Preiskampf bei einfach strukturierten Standard-HMOs gegen die großen Fermentations-Player wäre für ein Start-up kaum zu gewinnen. Primogenes entscheidender Wettbewerbsvorteil liegt jedoch in der Komplexität. Die industrielle Produktion von Molekülen wie DSLNT – das laut klinischen Studien signifikante gesundheitliche Vorteile speziell für Frühgeborene bietet – war bislang schlicht nicht möglich. Wenn Primogene hier durch sein starkes Patentportfolio die technologische Lücke schließt, umgeht das Unternehmen den harten Konkurrenzkampf im Massenmarkt.

Unser Fazit: Hohes Risiko, riesiger Hebel

Primogene ist kein schlankes Software-Projekt, sondern waschechtes DeepTech. Das bedeutet: Hohe regulatorische Hürden, langer Atem in der Forschung und massive Kapitalanforderungen. Die Seed-Finanzierung in Höhe von 4,1 Millionen Euro ist ein starker Vertrauensbeweis erfahrener Investoren, wird für den Anlagenbau und die Skalierung der Leipziger Produktion auf Dauer jedoch kaum ausreichen. Primogene muss nun rasch beweisen, dass die enzymatische Synthese nicht nur technologisch überlegen, sondern auch unter realen industriellen Kostendrücken skalierbar ist. Gelingt dieser Proof of Concept, hält das Start-up den Schlüssel zu einer neuen Generation komplexer, bioaktiver Moleküle in der Hand.

Cyber-Souveränität als Geschäftsmodell: QuoIntelligence sichert sich 7,3 Mio. Euro für den europäischen Markt

Regulierung als Wachstumstreiber: Das Frankfurter Cyber-Security-Start-up QuoIntelligence sammelt in seiner Series-A-Finanzierungsrunde 7,3 Millionen Euro ein. Das Versprechen: Hochwertige, fertig analysierte Cyber-Bedrohungsdaten speziell für den europäischen Mittelstand. Doch wie skalierbar ist der Spagat zwischen KI-Automatisierung und menschlicher Analyse, wenn man gegen etablierte US-Giganten antritt?

Der Weg von QuoIntelligence ist eng mit der Biografie seines Gründers Marco Riccardi verknüpft. Riccardi verbrachte sieben Jahre tief im IT-Sicherheitsapparat des Frankfurter Finanzsektors: Von 2013 bis 2015 war er als IT-Security-Berater für die Europäische Zentralbank (EZB) tätig, gefolgt von zwei Jahren als Threat Intelligence Analyst bei der Deutschen Bank. Vor der Gründung von QuoIntelligence Anfang 2020 leitete er zudem die Intelligence Operations beim Frankfurter Unternehmen QuoScient.

Heute führt Riccardi das Start-up mit einem europäisch aufgestellten Management-Team, dem unter anderem David Brown (UK), Antonio Arias Lopez (Deutschland), Odín Rodríguez Lago (Spanien) und Marina Gómez Lara (Spanien) angehören.

„Finished Intelligence“ statt roher Daten-Feeds

QuoIntelligence positioniert sich als Anbieter für „Unified Risk Intelligence“. Das Kernproblem vieler Unternehmen: Der Aufbau eines eigenen Cyber-Intelligence-Teams erfordert oft sechsstellige Investitionen allein für Fachpersonal. QuoIntelligence verspricht hier Abhilfe durch „Finished Threat Intelligence“ – fertig analysierte und kontextualisierte Bedrohungsinformationen, die innerhalb weniger Stunden einsatzbereit sind, ohne dass der Kunde ein eigenes internes Expertenteam benötigt.

Technologisch stützt sich das Unternehmen dabei auf zwei Säulen:

- Mercury: Die hauseigene Plattform aggregiert Erkenntnisse aus über 1.000 Quellen und nutzt eine kuratierte Wissensbasis von über 17.000 geprüften Intelligence-Tickets.

- KARLA: Ein konversationeller KI-Analyst soll diese komplexen Informationen für alle Unternehmensebenen – vom Vorstand bis zum Sicherheitsanalysten – zugänglich machen.

Das Modell stößt auf eine beachtliche Marktresonanz: Für das Jahr 2025 meldet das Startup keinen einzigen Kundenabgang (Zero Client Churn). Zudem hat sich der Customer Lifetime Value seit 2023 beinahe versechsfacht. Ein weiterer Vertrauensbeweis ist die Rolle als offizieller ENISA-Anbieter mit einem Vierjahresvertrag über 1,4 Millionen Euro seit Februar 2025.

Der Wachstumsmotor: NIS2, DORA und Daten-Souveränität

Die aktuelle Finanzierungsrunde wird von Elevator Ventures (Raiffeisen Bank International) angeführt und von der BMH Beteiligungs-Managementgesellschaft Hessen co-geführt. Beteiligt sind zudem eCAPITAL und Mercurius Private Equity. Dass hier vor allem Kapital mit starken Wurzeln im Finanzsektor fließt, ist strategisch logisch.

Der entscheidende Markttreiber sind die EU-Richtlinien NIS2 und DORA. Allein NIS2 erfasst europaweit über 160.000 Organisationen – davon über 30.000 in Deutschland – und führt zur persönlichen Haftung der Geschäftsführung bei Versäumnissen. Gleichzeitig fordern europäische Beschaffungsrahmen zunehmend, dass sensible Daten innerhalb der EU verbleiben. Hier zieht QuoIntelligence seinen entscheidenden Burggraben:

- Das Unternehmen ist nach deutschem Recht gegründet.

- Sämtliche Intelligence-Daten werden auf deutschem Boden unter EU-Recht gespeichert.

Die Herausforderungen

Trotz der strategisch klugen Positionierung gibt es Hürden:

- Skalierbarkeit: Das Modell setzt auf einen „Analyst-first“-Ansatz, bei dem Experten jede Information prüfen. Bei massivem Wachstum durch neue Vertriebskanäle muss die KI KARLA beweisen, dass sie diese Expert*innen effizient entlasten kann.

- Globale Konkurrenz: US-Schwergewichte wie CrowdStrike oder Mandiant verfügen über weit größere globale Daten-Netzwerke. QuoIntelligence setzt hier voll auf den Trumpf der „europäischen Souveränität“, um sich abzugrenzen.

- Mittelstands-Trägheit: Ob der Mittelstand über die reine Compliance-Erfüllung hinaus tatsächlich in tiefgehende Risiko-Intelligence investiert, wird das langfristige Wachstumstempo bestimmen.

Unser Fazit

QuoIntelligence zeigt sehr anschaulich, wie man Regulierung (NIS2/DORA) als stärksten Vertriebskanal nutzt. Die Wahl der Investor*innen aus dem Finanzsektor sichert den Zugang zur Kernzielgruppe. Mit der klaren Kante beim Datenschutz („Made in Germany“) besetzt das Start-up eine Nische, die für regulierte Unternehmen in Europa zur Pflicht wird. Gelingt der Spagat zwischen menschlicher Expertise und technischer Skalierung, könnte Frankfurt hier einen dauerhaften Champion der europäischen Cybersicherheit hervorbringen.

Omegga sichert 10 Mio. EUR gegen das Kükentöten

Das 2020 gegründete Münchner Start-up Omegga sichert sich Seed-Kapital für seine optische KI-Spektroskopie. Unsere Marktanalyse.

Omegga wurde 2020 von Katharina Hesseler, Till Nöllgen und Paul Günther gegründet. Zum erweiterten Gründer:innenkreis gehören zudem Moritz Eder, Kyle Hiroyasu und Clara Kaufhold. Das Team bündelt Expertise in den Bereichen KI, Optik und industrielle Systeme. In den vergangenen Jahren entwickelte das Team seine Technologie kontinuierlich vom Prototypen zum Industriestandard weiter und konnte sich bereits 2023 eine Pre-Seed-Finanzierung sowie 2024 Fördermittel des European Innovation Council (EIC) sichern.

CEO und Mitgründerin Katharina Hesseler sieht in dem Einstieg der neuen Partner, die „tiefes technologisches Verständnis mitbringen“, ein „starkes Signal für das enorme Potenzial unseres Ansatzes, einen neuen Standard in der Industrie zu setzen“. Das frische Kapital soll in den gezielten Ausbau des Teams und die kommerzielle Skalierung der Technologie fließen.

Das Problem und die technologische Lösung

Der erste und bereits kommerziell verfügbare Use Case von Omegga widmet sich einem der massivsten ethischen Probleme der modernen Landwirtschaft. Jährlich werden weltweit Milliarden männlicher Küken direkt nach dem Schlüpfen getötet, da sie weder Eier legen noch für die Masthaltung wirtschaftlich nutzbar sind.

Mit der sogenannten spektralen Intelligenz – der Kombination aus KI und Spektroskopie – will Omegga das Unsichtbare sichtbar machen. Im Gegensatz zu vielen Marktbegleitern wählt Omegga einen rein optischen, nicht-invasiven Weg. Durch spezielle Kameras und Lichtfrequenzen werden die Eier im Brutkasten gescannt. Laut eigenen Angaben bietet das Start-up damit die früheste am Markt kommerziell verfügbare Technologie, um das Geschlecht noch vor dem Schlüpfen zu bestimmen. Das System ist bereits bei Kund*innen im laufenden industriellen Produktionsbetrieb im Einsatz.

Markt, Wettbewerb & regulatorischer Druck

Der Markt für das „In-Ovo-Sexing“ wächst rasant, primär getrieben durch den Gesetzgeber. In Deutschland ist das Kükentöten seit 2022 gesetzlich verboten, Frankreich zog nach, und ein EU-weites Verbot wird debattiert. Der Zwang zur Adaption in den Brütereien ist entsprechend hoch.

Omegga tritt in ein Feld ein, das bereits von finanzstarken Konkurrenten besetzt ist:

SELEGGT: Gilt als früher Pionier auf dem Markt. Das Unternehmen nutzt hormonelle Tests am 9. Bruttag, wofür das Ei mittels eines Lasers winzig klein geöffnet werden muss (minimal-invasiv).

In Ovo: Das niederländische Unternehmen setzt auf Flüssigkeitsanalysen mittels Massenspektrometrie am 9. Bruttag und sicherte sich erst kürzlich ein 42-Millionen-Euro-Darlehen der Europäischen Investitionsbank (EIB).

Agri Advanced Technologies (AAT): Die Tochter der EW Group dominiert weite Teile des Marktes mit hyperspektraler Bildgebung, die primär für braune Eier zwischen dem 11. und 13. Tag genutzt wird.

Der entscheidende Vorteil von Omegga: Die Methode kommt völlig ohne Verbrauchsmaterialien wie Chemikalien oder feine Nadeln aus. Da die Eier bei der rein optischen Methode unversehrt bleiben, entfällt das systembedingte Kontaminationsrisiko, das bei invasiven Verfahren entstehen kann.

Unsere Einordnung

Trotz der vielversprechenden Technologie steht Omegga vor Herausforderungen:

Hardware-Skalierung in rauen Umgebungen: Die Systeme müssen in den feuchten, warmen und staubigen Inkubatoren industrieller Brütereien über Jahre hinweg wartungsarm laufen. Hier muss das Start-up beweisen, dass sich die Technologie reibungslos in den globalen Massenbetrieb integrieren lässt.

Der regulatorische „Faktor Zeit“: Rein optische Modelle benötigen oft bis zum 12. Tag für eine verlässliche Auswertung. Sollte die Politik die „Tag 6“-Frist künftig strikt durchsetzen, müssen die KI-Modelle von Omegga beweisen, dass sie derart früh hochpräzise Ergebnisse liefern.

Die Plattform-Vision – Fluch oder Segen?

Omegga positioniert seine Lösung ausdrücklich als Plattformtechnologie für die Landwirtschaft, Lebensmittelproduktion und industrielle Qualitätskontrolle. Wie stark dieses Narrativ bei den Geldgebern verfängt, zeigen die Statements zur aktuellen Runde: Laut Christian Knott (Capnamic) entsteht hier eine Technologie „mit dem Potenzial, gleich mehrere Industrien grundlegend zu verändern“. Auch Mason Sinclair (IQ Capital) lobt die Schaffung einer „Plattform für die nicht-invasive und branchenübergreifende Materialanalyse“.

Dass solche Visionen bei Investor*innen beliebt sind, da sie den adressierbaren Markt massiv vergrößern, ist nachvollziehbar. Für ein 17-köpfiges Start-up birgt die gleichzeitige Erschließung neuer Industriezweige jedoch die Gefahr einer operativen Verzettelung. Der Fokus muss zunächst darauf liegen, den Geflügelmarkt zu durchdringen.

Fazit

Gelingt es Omegga, die rein optische Methode in der Breite zu skalieren und die Genauigkeit auf die allerersten Bruttage zu trainieren, hat das Münchner Start-up einen signifikanten Hebel gegen invasiv arbeitende Wettbewerber. Die 10-Millionen-Euro-Runde ist ein klarer Vertrauensbeweis der Investor*innen in einem schwierigen Funding-Umfeld.

Energie-Betriebssystem fürs Mehrfamilienhaus: Berliner Start-up VREY sichert sich 3,3 Millionen Euro Seed-Kapital

Das Climate-Tech-Start-up VREY sammelt eine Millionenfinanzierung ein, um sich als zentrales „EnergyOS“ für Vermieter*innen zu etablieren. Doch der Markt ist umkämpft und hält operative Tücken bereit.

VREY (rechtlich firmierend unter RE Joule GmbH ) hat den Abschluss einer Seed-Finanzierungsrunde in Höhe von 3,3 Millionen Euro bekannt gegeben. Angeführt wird die Runde von Rubio Impact Ventures. Als weitere Investor*innen steigen der High-Tech Gründerfonds (HTGF) sowie der Impact-Investor Kopa Ventures ein. Das frische Kapital soll in die Skalierung des aktuell rund 20-köpfigen Teams sowie in die Weiterentwicklung der eigenen Software-Plattform fließen.

Warum PV auf Mietshäusern bisher oft scheiterte

Solaranlagen auf Einfamilienhäusern sind längst ein Erfolgsmodell, doch auf Mehrfamilienhäusern galten sie lange als operativ komplex und wirtschaftlich wenig attraktiv. Der Hauptgrund: Vermieter*innen, die ihren Mieter*innen Strom vom eigenen Dach anbieten wollten, fielen beim klassischen Mieterstrom-Modell schnell in die Pflichten eines vollwertigen Energieversorgers. Sie mussten unter anderem eine Vollversorgung garantieren – also auch dann Reststrom einkaufen und liefern, wenn die Sonne nicht schien. Komplexe Abrechnungsprozesse und teure Messtechnik schreckten zusätzlich ab.

Mit der Einführung der „Gemeinschaftlichen Gebäudeversorgung“ (GGV) entfällt ein Großteil dieser Hürden, insbesondere die Notwendigkeit für Eigentümer*innen, selbst als Energieversorger*innen aufzutreten.

VREY als „EnergyOS“

Genau auf diese regulatorische Neuerung setzt VREY. Das Start-up kombiniert eine automatisierte Abrechnungssoftware mit der Zulassung als zertifizierter Messstellenbetreiber. VREY positioniert sich damit als eine Art Betriebssystem („EnergyOS“) für die Messung, Abrechnung und Steuerung von Energieflüssen im Mehrfamilienhaus.

Die Wertschöpfung ist in der Theorie für alle Parteien lukrativ:

- Vermieter*in: Eine typische 30-kWp-Anlage auf einem Zehn-Parteien-Haus kann laut VREY rund 5.500 Euro an zusätzlichen jährlichen Einnahmen generieren.

- Mieter*in: Bewohner*innen können ihren Strom bis zu 20 Prozent günstiger beziehen, was laut Unternehmensangaben jährlichen Einsparungen von etwa 120 bis 250 Euro entspricht.

Hohes Tempo seit Gründung

Gegründet wurde VREY im Jahr 2024 von Julius Pahmeier und Cedric Jaeger. Das Tempo des Gründerduos ist beachtlich: Laut Unternehmensangaben hat VREY bereits eine dreistellige Anzahl von Projekten in allen 16 Bundesländern umgesetzt. Die Kundschaft reicht von privaten Vermietern bis hin zu großen Immobilienunternehmen und Wohnungsbaugenossenschaften.

Flaschenhälse und Konkurrenzkampf

Der adressierbare Markt für VREY ist mit über 20 Millionen potenziellen Wohneinheiten in Deutschland enorm. Doch das Start-up bewegt sich keinesfalls im luftleeren Raum.

Der Wettbewerb: Die Marktchancen der GGV haben auch andere Player erkannt. Etabliertere Lösungsanbieter wie Einhundert Energie, Metergrid, Pionierkraft oder das zu Enviria gehörende prosumergy adressieren den Markt für dezentrale Energieversorgung teils seit Jahren mit eigenen Hard- oder Softwarelösungen. VREY muss in der Praxis beweisen, dass die eigene Plattform-Architektur der Konkurrenz langfristig überlegen ist.

Operative Hürden: Obwohl die gesetzlichen Rahmenbedingungen verbessert wurden, ist die Umsetzung oft steinig. Branchenverbände wie die Deutsche Gesellschaft für Sonnenenergie (DGS) kritisieren, dass die Umsetzung der GGV in Deutschland derzeit vielerorts an strukturellen Blockaden der klassischen, grundzuständigen Messstellenbetreiber scheitert. Es kommt zu Verzögerungen beim zwingend notwendigen Einbau intelligenter Messsysteme (Smart Meter).

VREY umgeht diesen Flaschenhals clever, indem das Unternehmen selbst als zertifizierter Messstellenbetreiber agiert und sich so autark von lokalen Netzbetreiber*innen macht. Dennoch bleibt eine zweite operative Hürde bestehen: Die Installation der Anlagen. Hier verlässt sich VREY auf lokale, frei wählbare Installationsbetriebe. Das Wachstum des Start-ups korreliert somit unweigerlich mit den Kapazitäten und dem anhaltenden Fachkräftemangel im deutschen Handwerk.

Fazit

VREY zeigt, wie Start-ups durch neue regulatorische Rahmenbedingungen Märkte erschließen können, die vorher als unprofitabel galten. Die Kombination aus Software-Abrechnung und der Lizenz als eigener Messstellenbetreiber ist ein starker USP, um bürokratische Trägheit zu umschiffen. Mit der soliden Seed-Finanzierung im Rücken hat das Team nun den nötigen Spielraum, um im Kampf um die deutschen Mietshaus-Dächer eine entscheidende Rolle einzunehmen – sofern die Koordination mit dem Handwerk reibungslos skaliert.

Nox Mobility: 2 Mio. EUR für den "Flugzeug-Killer" auf Schienen

Das Berliner Start-up Nox Mobility will mit privaten Zimmern im Nachtzug europäische Kurzstreckenflüge ersetzen. Eine 2-Millionen-Euro-Pre-Seed-Runde gibt erste Starthilfe. Doch der europäische Bahnmarkt ist ein hartes Pflaster für Gründende – erst 2024 scheiterte ein französischer Konkurrent mit exakt demselben Konzept. Eine Einordnung.

Es ist ein mutiges Versprechen in einem der am stärksten regulierten Märkte Europas: Das 2025 gegründete Mobilitäts-Start-up Nox Mobility will das europäische Nachtzug-Erlebnis revolutionieren. Dafür hat das Unternehmen nun eine Pre-Seed-Finanzierungsrunde in Höhe von 2 Millionen Euro abgeschlossen. Angeführt wird die Runde vom Frühphasen-Investor IBB Ventures. Mit an Bord sind zudem der italienische Investor Tommaso Lucca sowie Branchenköpfe wie HomeToGo-Mitgründer und CEO Dr. Patrick Andrae. Das frische Kapital soll primär in den Teamaufbau, die Vorbereitung der ersten Strecken für das Jahr 2027 sowie den Bau eines originalgetreuen Mockups der Zugkabinen fließen.

Rollendes Boutique-Hotel statt Abteilromantik

Während Nachtzüge aktuell zwar einen massiven Nachfrageboom erleben, ist der eigentliche Markt laut Nox Mobility zwischen 2001 und 2019 drastisch geschrumpft – von rund 1.200 wöchentlichen Verbindungen in Europa auf nur noch etwa 450. Nox will diese Lücke nun schließen und positioniert sich explizit nicht als klassisches Bahnunternehmen, sondern als direkte Alternative zum Kurzstreckenflug.

Der Clou: Das traditionelle Teilen von Schlafabteilen mit Fremden entfällt; stattdessen bekommt bei Nox Mobility jede(r) Reisende sein eigenes privates Zimmer mit Schlafplatz. Die Reise verbinde laut Nox die Zuverlässigkeit des Fliegens operativ mit dem Gefühl eines Boutique-Hotels. Abfahrten sollen abends an zentralen Bahnhöfen stattfinden, die Ankunft morgens direkt im Stadtzentrum – Flughafentransfers und Sicherheitskontrollen entfallen. Zielgruppe sind neben Freizeitreisenden vor allem Geschäftsreisende, für die eine Zugfahrt den frühen Abflug und eine zusätzliche Hotelübernachtung ersetzen soll. Preislich will Nox auf dem Niveau vergleichbarer Flugreisen agieren.

Das Gründerteam: Reichweite trifft auf operative Härte

Hinter dem Projekt steht ein Trio, das Branchenerfahrung, Skalierungswissen und bereits jetzt eine enorme Zielgruppe vereint:

Artur Hasselbach bringt als Mitgründer des Payment-Fintechs orderbird – das für über 140 Millionen Euro von Nexi übernommen wurde – ausgewiesene VC- und Tech-Erfahrung mit.

Janek Smalla kennt das harte operative Mobilitätsgeschäft aus seinen vorherigen Stationen bei FlixTrain und dem Mobilitätsanbieter Bolt.

Thibault Constant ist in der Nische ein Star: Mit "Simply Railway" hat er eine der größten Eisenbahn-Communities Europas mit über 600.000 Abonnenten aufgebaut. Er kennt die Probleme der Fahrgäste aus unzähligen Gesprächen und Zugfahrten aus erster Hand.

Die Gründer geben sich selbstbewusst und verkünden, das Rollmaterial für die Züge bereits gesichert zu haben.

Unsere Markteinordnung

Für uns stellt sich jedoch eine zentrale Frage: Kann man mit 2 Millionen Euro Pre-Seed-Kapital tatsächlich einen hochkomplexen Bahn-Infrastrukturbetrieb aufbauen? Die Antwort lautet: Nein, es ist lediglich das Ticket, um überhaupt an den Start zu gehen. Der Bau eines Mockups in Originalgröße ist das eine – die Finanzierung und Zulassung echter Züge für den Betrieb ab 2027 kostet schnell dreistellige Millionenbeträge.

Besonders kritisch wird das Vorhaben mit Blick auf die Konkurrenz und die jüngere europäische Start-up-Historie. Die Idee eines rollenden Hotels mit ausschließlich privaten Abteilen ist nicht neu. Das französische Start-up Midnight Trains startete 2020 mit extrem viel PR und fast exakt demselben Geschäftsmodell. Im Juni 2024 musste das Projekt jedoch Insolvenz anmelden. Die Gründer scheiterten daran, dass europäische VCs und Banken das massive finanzielle Risiko nicht tragen wollten und die europäische Schieneninfrastruktur historisch stark auf staatliche Monopolisten zugeschnitten ist, was neue Player systematisch benachteiligt.

Gleichzeitig schläft der etablierte Markt nicht: Die Österreichischen Bundesbahnen (ÖBB) dominieren mit ihrem Nightjet das Geschäft und haben mit ihren neuen „Mini Cabins“ (Schlafkapseln für Einzelpersonen) bereits auf den Wunsch nach mehr Privatsphäre reagiert.

Eine hochriskante Kapitalwette

Nox Mobility löst zweifellos ein echtes Problem und trifft den Nerv der Zeit in Sachen nachhaltiger Mobilität. Das Team aus Hasselbach, Smalla und Constant ist hervorragend aufgestellt und die Tatsache, dass sie nach eigenen Angaben bereits Züge gesichert haben, könnte der entscheidende Wettbewerbsvorteil gegenüber gescheiterten Projekten wie Midnight Trains sein.

Dennoch bleibt Nox Mobility eine hochriskante Kapitalwette. Die spannende Bewährungsprobe für das Berliner Start-up beginnt nicht erst 2027 auf den Schienen, sondern bereits in der nächsten Finanzierungsrunde: Dann wird sich zeigen, ob das Team Investor*innen davon überzeugen kann, die enormen Summen für den realen Bahnbetrieb aufzubringen – oder ob der Traum vom Start-up-Nachtzug im Trassendschungel Europas stecken bleibt.

UniteLabs: Der Münchner DeepTech-Herausforderer auf dem Weg zum globalen Labor-Standard?

Das 2024 von Robert Zechlin, Lukas Bromig und Julian Willand gegründete UniteLabs will die Laborautomatisierung von proprietären Hürden befreien. Nach einer Millionenfinanzierung folgte Anfang 2026 der offizielle US-Launch. Wir wollten wissen: Wie realistisch ist die Vision eines herstellerunabhängigen Standards in einem von Hardware-Silos dominierten Markt? Eine Analyse.

Wer heute ein hochmodernes BioTech-Labor betritt, erwartet nahtlos vernetzte HighTech-Forschung. Die Realität sieht oft anders aus: Rund 90 Prozent der Laborgeräte stammen von unterschiedlichen Hersteller*innen und sprechen schlichtweg nicht dieselbe technische Sprache. Um künstliche Intelligenz in der Forschung nutzbar zu machen, müssen hochqualifizierte Wissenschaftler*innen oft als Software-Ingenieur*innen einspringen und mühsam Schnittstellen programmieren. Genau diesen Flaschenhals will das Münchner DeepTech-Start-up UniteLabs beseitigen.

Die Gründer und der Sprung aus München

Hinter UniteLabs stehen Robert Zechlin, Lukas Bromig und Julian Willand. Nach Vorarbeiten ab 2022 wurde das Unternehmen 2024 offiziell gegründet. Das Team vereint interdisziplinäre Expertise aus Chemieingenieurwesen, Wirtschaftsinformatik und Unternehmensstrategie – eine essenzielle Mischung für ein Produkt, das tiefes Prozessverständnis mit modernster Softwarearchitektur verbinden muss.

Dass die Idee einen massiven Schmerzpunkt der Industrie trifft, zeigt die rasante Entwicklung der letzten Monate. Nach einer Pre-Seed-Finanzierungsrunde in Höhe von 2,77 Millionen Euro unter der Führung von NAP (ehemals Cavalry Ventures) im Januar 2025 und der Auszeichnung als „Bestes Münchner Start-up“ beim Munich Startup Award 2025 ist das Unternehmen sichtlich gewachsen. Im ersten Quartal 2026 zählt das Team im Münchner Inkubator Werk1 bereits rund 28 Köpfe.

Doch wie verhindert ein derart rasant wachsendes Team, bei der ständigen Anbindung neuer, exotischer Hardware nicht zu einer hochbezahlten IT-Manufaktur zu verkommen? Schließlich erfordert jedes neue Laborgerät auf dem Markt zunächst einmal Entwicklungsaufwand für den passenden Konnektor.

„Unser Ziel ist nicht, jedes exotische Gerät einzeln ‚irgendwie‘ anzubinden“, stellt Mitgründer Robert Zechlin klar. Vielmehr soll die Integration zu einer wiederholbaren Produktfähigkeit reifen. Statt sich im Klein-Klein der Modellnummern zu verlieren, baue UniteLabs seine Konnektoren entlang grundsätzlicher Geräte-Fähigkeiten. Die puren Herstellerspezifika landen dabei in einer dünnen Adapter-Schicht, während Workflows und Datensemantik konsistent bleiben.

Um die berüchtigte Skalierungsfalle zu umgehen, setzt das Start-up zudem verstärkt auf „Reusable Automation Assets“. „Wir investieren in validierte Workflow-Bausteine, Device-Profile und Test-Suites, mit denen die zweite und dritte Integration deutlich schneller wird als die erste“, betont Zechlin und skizziert damit den Weg zum echten SaaS-Unternehmen. Der Gründer gibt die Richtung selbstbewusst vor: „Die Grenzkosten für das nächste Gerät und den nächsten Standort müssen über Zeit sinken. Unser Endzustand ist ein Ökosystem, in dem Integrationen gemeinsame Infrastruktur sind, nicht Projektgeschäft.“

Vom Prototyp zur Architektur der offenen Labore

Im Februar 2026 hat UniteLabs auf der renommierten Branchenmesse SLAS in Boston den offiziellen US-Launch seines „AI-Ready Lab Automation Systems“ vollzogen. Statt nur isolierte Schnittstellen zu flicken, positioniert sich das Start-up nun mit einer klaren, dreiteiligen Architektur.

Den Kern bildet die Cloud-native „UniteLabs Platform“, die Hardware vernetzt und die Integration von Machine-Learning-Modellen in Echtzeit erlaubt. Ergänzt wird dies durch die lokale Anwendung „GroundControl“ für den Plug-and-Play-Anschluss von Geräten sowie das „UniteLabs SDK“. Letzteres ist ein Python-Werkzeug für Wissenschaftler*innen, um Labor-Workflows komplett als Code zu steuern. Dass diese Theorie praxistauglich ist, beweist das aufstrebende KI-BioTech-Unternehmen Cradle, das die Lücke zwischen Maschinen und digitalen Daten-Lakes intern bereits mit dem Münchner System schließt. Laut UniteLabs soll sich der Labor-Durchsatz für solche KI-getriebenen Forschungsteams durch die Plattform um bis zu das Vierfache steigern lassen.

Ein „Lab-as-Code“-Ansatz via Python mag für entwickleraffine Data Scientists verlockend sein – doch schließt er nicht paradoxerweise die klassischen Biolog*innen aus, für die Code-Workflows oft eine zu steile Lernkurve bedeuten?

„Code ist nicht das Produkt“, kontert Zechlin. Er sei vielmehr eine Schnittstelle, die sowohl Power-User als auch den Laboralltag bedienen müsse. Das SDK richte sich an Teams, die volle Kontrolle über Versionierung und automatisierte Tests verlangen – was im KI-BioTech-Umfeld zunehmend Standard sei. Zechlin räumt jedoch ein, dass das Programmieren nicht jedem liege: „Die meisten wollen zuverlässige Ausführung und klare Transparenz.“

Die Lösung der Münchner: Über die Orchestrierungsschicht und „GroundControl“ werden Workflows paketiert und mit Leitplanken versehen, sodass sie auch für Nicht-Entwickler sicher ausführbar sind. Code bleibt strategisch zwar die „universelle Abstraktion“ über Geräte hinweg, doch das Interface der Zukunft sieht anders aus. Zechlin blickt voraus: „Das User Interface für Wissenschaftler wird zunehmend KI-gesteuert und natürliche Sprache zum primären Interface. UniteLabs dient diesen KI-Applikationen als robuste Surface Area und Source of Truth.“ Die Leitplanke für das Wachstum fasst er in einem Satz zusammen: „Unsere Vision ist: flexibel, wo es Sinn macht, und kompromisslos robust, wo es zählen muss.“

Die Bewährungsprobe auf dem US-Markt

Nach dem Bostoner Launch steht das Start-up nun vor der monumentalen Aufgabe, sich im hochkompetitiven US-Markt zu behaupten. Hier entscheidet sich, ob UniteLabs vom europäischen Hoffnungsträger zum globalen Player reift. Umgeben von gigantischen Investitionen in die KI-Wirkstoffentwicklung reicht es nicht, nur ein weiteres Automatisierungstool zu sein – UniteLabs muss sich als essenzieller „Schaufelhersteller“ für den aktuellen Boom etablieren.

Dabei trifft man auf amerikanische Wettbewerber*innen, die teils mit hunderten Millionen Dollar Venture Capital ausgestattet sind. Wie überlebt ein Münchner Start-up mit einer Pre-Seed-Runde von knapp drei Millionen Euro diese Materialschlacht? Zechlin gibt sich pragmatisch und weicht dem direkten Finanz-Vergleich aus: „Klar: In Infrastrukturmärkten hilft Kapital, aber es ist nicht der entscheidende Hebel.“ Anstatt die Konkurrenz im reinen „Spend“ schlagen zu wollen, baue man auf messbaren Nutzen im Laborbetrieb.

Der Plan scheint aufzugehen: Ein Großteil von Umsatz und Pipeline stammt heute bereits aus den USA, wo UniteLabs Kund*innen an beiden Küsten bedient und mit großen Hardware-Hersteller*innenn kooperiert. „Wir planen für dieses Jahr unseren ersten Big Pharma Roll-out, der sowohl in Europa als auch an Standorten in den USA erfolgen soll“, verrät der Gründer. Um diese Dynamik zu finanzieren, hebe man aktuell eine 9-Millionen-Euro-Seed-Runde für die US-Expansion. Den strukturellen Wettbewerbsvorteil sieht Zechlin in der herstelleragnostischen Verbindung bestehender Geräte: „Statt Rip-and-Replace zu verlangen, werden Workflows schneller produktiv, Daten werden sauber mit Kontext versehen, und Teams können ‚Lab-as-Code‘ wirklich ausrollen.“

Ein strategischer Hebel ist dabei die Zielgruppenansprache. Statt in endlosen Vertriebszyklen mit dem C-Level großer Pharma-Konzerne zu ringen, treibt UniteLabs ein nutzer*innengetriebenes Wachstum voran. Labor-Ingenieur*innen, die durch das Python-SDK wochenlange Schnittstellenprogrammierung einsparen, tragen das System organisch in ihre Unternehmen. Dabei profitiert das Start-up enorm davon, selbst keine Pipettierroboter oder Analysegeräte herzustellen. Als „neutrale Schweiz“ der Labor-Hardware buhlt UniteLabs nicht um lukrative Geräteverkäufe – ein extrem starkes Argument gegen den gefürchteten Vendor-Lock-in amerikanischer Hardware-Giganten.

Stresstest für das Geschäftsmodell und Regularien

Doch die ambitionierte Plattform-Strategie wird kritisch geprüft werden. Das Geschäftsmodell birgt ein ständiges API-Katz-und-Maus-Spiel, da Schnittstellen zu teils stark abgeschirmten Systemen gebaut werden müssen. Wenn etablierte Hersteller*innen ihre Firmware ändern oder Drittanbieter-Zugriffe blockieren, explodieren schnell die Wartungskosten für die Konnektoren.

Bleibt die Frage an den Gründer: Was ist also der Plan B, wenn die Marktführer ihre Schnittstellen per Update plötzlich aktiv verschlüsseln? Reicht der Verweis auf offene Standards wie das SiLA2-Protokoll in der harten Praxis aus?

„Wir gehen davon aus, dass Hersteller ihre Ökosysteme schützen werden. Unsere Strategie darf deshalb nicht auf ‚Goodwill‘ bauen“, gibt sich Zechlin keinen Illusionen hin. Standards wie SiLA2 seien zwar hilfreich gegen Fragmentierung, aber „kein Schutzschild“. Der Ansatz der Münchner ist stattdessen pragmatisch und mehrstufig: Standards nutzen, wo verfügbar, und eigene robuste Adapter bauen, wo nötig. Zudem betreibe man ein Programm mit automatisierten Regressionstests am realen Geräteverhalten, um Fehler durch Updates früh zu erkennen.

Der zweite Baustein der Verteidigung ist kommerzieller Druck. Da Labore zunehmend „Best-of-Breed“-Lösungen kombinieren wollen, würden Hersteller, die Interoperabilität blockieren, zunehmend Deals riskieren. Im Hintergrund investiere man deshalb viel Arbeit in aktiv gepflegte Partnerschaften mit den Produzent*innen. Zechlins Plan B lautet letztlich Resilienz: „Mehrere Integrationspfade, starke Tests, und ein System, das stabil bleibt, auch wenn sich die Oberfläche verändert.“ Er ist sich sicher: „Langfristig wirkt die Ökonomie in Richtung Offenheit.“

Neben blockierender Hardware bleibt die US-Zulassungsbehörde FDA die vielleicht höchste Hürde auf dem Weg in den Enterprise-Markt. Deren strenge Vorgaben zu elektronischen Aufzeichnungen sind der größte Vorbehalt von Pharmaunternehmen gegenüber Cloud-basierten Systemen. Gelingt es UniteLabs, Offenheit mit lückenlosen Audit-Trails zu verknüpfen, könnten sie die berüchtigten Sales-Zyklen drastisch verkürzen.

Doch wie passt maximale Entwickler*innen-Freiheit durch Python-Skripte mit rigider FDA- und GxP-Compliance zusammen? Für Zechlin existiert dieser Widerspruch im Labor-Alltag schlichtweg nicht: „Compliance widerspricht Flexibilität nicht. Was widerspricht, ist unkontrollierte Veränderung.“

Um Big Pharma gerecht zu werden, behandle man hochflexible Workflows wie reguläre Software-Produkte: versioniert, testbar und auditierbar. „Ein Script ist in einem GxP-Kontext kein ‚jeder macht, was er will‘, sondern ein kontrolliertes Artefakt mit definierten Inputs, erwarteten Outputs und einem Validierungsnachweis“, unterstreicht der Mitgründer. Die Plattform trenne Sandbox-Entwicklungen von einer strikt kontrollierten Produktionsebene mit signierten Releases, Environment-Pinning und klarer Datenlineage. Zechlin formuliert einen selbstbewussten Anspruch an die Branche: „Das Labor holt Software-Best-Practices nach. Unser Anspruch ist, ‚compliant by design‘ zur Default-Einstellung für AI-ready Lab Ops zu machen.“

Fazit

UniteLabs hat exzellentes Timing bewiesen. Die BioTech-Branche lechzt nach KI, scheitert aber noch massenhaft an isolierten Daten. Durch das Bereitstellen essenzieller Daten-Infrastruktur haben sich die Münchner in eine starke Ausgangsposition manövriert. Der US-Launch und anstehende Messepräsentationen zeugen vom Anspruch der Gründer. Der ultimative Lackmustest ab 2026 wird jedoch sein, ob die Hardware-Hersteller*innen diesen Wandel dulden – oder den Kampf um ihre lukrativen Software-Margen eröffnen.

Bleibt die Frage nach dem viel zitierten „Endgame“: Baut das Start-up wirklich das globale Betriebssystem für Biotech-Labore, oder macht man sich letztlich nur als hochattraktives Übernahmeziel für Hardware-Giganten hübsch?

Auf diese Entweder-Oder-Frage antwortet Zechlin diplomatisch, aber ambitioniert: „Unsere Vision ist, die neutrale Betriebsschicht für moderne Labore zu werden, weil die Branche einen herstellerunabhängigen Standard braucht, nicht noch ein weiteres Einzellösungstool.“ Gleichzeitig sei man Realist: Infrastruktur zähle nur, wenn sie im Alltag zuverlässig genutzt werde und verlässliche, strukturierte Daten für KI liefere.

Sollte das gelingen, hält sich UniteLabs alle Optionen offen – von der unabhängigen Kategorie-Definition über strategische Partnerschaften bis hin zum Exit. Doch auf einen schnellen Verkauf schiele man nicht, verspricht Zechlin: „Wir bauen nicht für eine Übernahme. Wir bauen so, dass der Markt die Plattform ernst nehmen muss.“ Und am Ende solle ohnehin der/die Kund*in profitieren: „Weniger Silos, schnellere Science, und ein Ökosystem, in dem Innovation nicht an proprietären Schnittstellen hängen bleibt.“

Gründer*in der Woche: Pax Lupus – Mit KI und Drohnen gegen den Wolf

Wolfsbiss in Hamburg: Die Debatte brennt. Das Start-up Pax Lupus von Anna-Karina Katt und Karsten Schmiegel will Herden nun autonom mit KI und Drohnen schützen.

Die Rückkehr des Wolfes nach Deutschland erreicht eine neue Eskalationsstufe: Am 30. März 2026 kam es in einem Einkaufszentrum in Hamburg-Altona zur Bissverletzung einer Frau durch einen Wolf. Es ist der erste Vorfall dieser Art seit der Wiederansiedlung der Tiere vor fast 30 Jahren. Obwohl die betroffene Frau das Universitätsklinikum nach ambulanter Behandlung inzwischen verlassen konnte, ist die Debatte um den Umgang mit dem Raubtier voll entbrannt.

Alexander Bonde, Generalsekretär der Deutschen Bundesstiftung Umwelt (DBU), stellt in diesem Kontext klar: Aus Artenschutzperspektive sei die Rückkehr des Wolfs positiv, doch Wölfe gehören in die Natur und nicht in Städte. Für die freie Natur komme es laut Bonde nun auf wirtschaftliche und praktische Schutzmechanismen an, die ein Nebeneinander von Wild- und Nutztieren ermöglichen. Genau hier setzt das von der DBU mit der „Green Startup“-Förderung unterstützte Unternehmen Pax Lupus an.

Gründer*innen & Vision

Hinter Pax Lupus steht das Gründungsduo Anna-Karina Katt und Karsten Schmiegel. Die beiden haben sich dem Thema Herdenschutz verschrieben und entwickeln ein autonomes System zur nicht-tödlichen Abwehr von Wolfsrudeln. Ihre Motivation speist sich auch aus der Kritik an gängigen Praktiken: Laut Anna-Karina Katt seien etablierte Maßnahmen wie Zäune, Netze und Herdenschutzhunde nicht nur arbeitsintensiv, sondern teils auch umweltschädigend. Besonders die engmaschigen Kunststoffnetze seien kurzlebig und produzierten große Mengen an nicht-recyclebarem Müll. Ein weiteres Problem laut Katt: Andere Wildtiere wie Rehe oder Feldhasen verfangen sich in diesen Netzen, was nicht selten zu schweren Verletzungen oder gar zum Verenden führe.

Das Produkt: Autonome Luftabwehr statt Plastiknetz

Das von Katt und Schmiegel entwickelte Herdenschutzsystem soll völlig netzunabhängig und nach einem mehrstufigen Prinzip auf Basis künstlicher Intelligenz (KI) arbeiten. Für die Überwachung und Sensorik wird in der Mitte der Weide ein Mast aufgestellt, der mit Kameras und Sensoren ausgestattet ist und über Solarmodule mit Strom versorgt wird. Diese Sensoren überwachen Tag und Nacht einen Radius von bis zu 200 Metern und sollen erkennen, wenn sich ein Wolf nähert. Die entwickelte Technik soll dabei zuverlässig Menschen oder andere Tiere von Wölfen unterscheiden, sodass bei harmlosen Weidebesuchern kein Alarm ausgelöst wird.

Wird tatsächlich ein Wolf registriert, eskalieren die Abwehrmaßnahmen schrittweise zur Vergrämung. Aus der Basisstation steigt eine kleine Drohne auf, fliegt das Tier gezielt an und soll es durch entsprechende Manöver vertreiben. Um auch eine Echtzeit-Intervention zu ermöglichen, werden die Schäferinnen und Schäfer bei bestehender Netzabdeckung zeitgleich über den Vorfall alarmiert. Sie können die Lage dann über Kameras zusätzlich einschätzen und die Drohnen-Abwehr bei Bedarf manuell abbrechen. Laut Anna-Karina Katt vertreibt das System Wölfe nicht nur situativ: Durch wiederholte Vergrämung sollen Wölfe lernen, die Weidetiere auch langfristig zu meiden. Dies ermögliche es den Schäfer*innen, lediglich einen einfachen Grundschutz wie Weidezäune aufzustellen.

Geschäftsmodell & Marktanalyse

Pax Lupus bewegt sich in der wachsenden Nische des Agri-Tech und liefert einen innovativen Ansatz für ein hoch emotionales und drängendes Problem in der Landwirtschaft. Beim Vertrieb setzt das Start-up auf den Verkauf sowie das Leasing des Systems und bietet zudem die Übernahme der Wartung an. Die darüber hinaus geplanten „Notfall-Mieten“ bei akuten Wolfsrissen sind strategisch klug positioniert. Damit senkt Pax Lupus die Einstiegshürde für betroffene Schäfer*innen enorm und platziert das Produkt direkt dort, wo der akute Bedarf entsteht.

Der rein deutsche Markt für Wolfsschutz ist trotz stetig wachsender Population zunächst auf klassische Weidebetriebe limitiert. Um als Start-up skalieren zu können, ist die von Pax Lupus geplante Ausweitung auf andere Nutztiere wie Kühe, Pferde oder Hühner entscheidend. Das angedachte KI-Training zur Abwehr von weiteren Raubtieren wie Füchsen oder Kojoten öffnet zudem potenziell die Tür zu internationalen Märkten.

Die stärksten Wettbewerber*innen bleiben vorerst etablierte Zäune und Herdenschutzhunde. Pax Lupus muss beweisen, dass die Gesamtkosten ihres Hightech-Systems für oft margenschwache Weidebetriebe attraktiv sind. Zudem stehen Hardware-Startups immer vor physischen Hürden: Die Solartechnik und Drohnenmechanik müssen auch bei widrigem Wetter fehlerfrei funktionieren.

Fazit

Pax Lupus kombiniert auf clevere Weise Tierschutz mit moderner KI und entlastet Weidetierhalter. Gelingt es dem Startup, die Hardwarekosten wettbewerbsfähig zu halten und die Software zügig auf weitere Raubtierarten auszuweiten, könnte dieses System den Herdenschutz nachhaltig verändern. Letztlich schützt Technologie hier nicht nur das Schaf, sondern hilft laut Anna-Karina Katt auch, artenreiche Offenlandschaften wie Bergweiden, Heide und Deiche als wichtigen Bestandteil Mitteleuropas zu erhalten.

Strategischer Exit: food42morrow übergibt seine Getränkemarke JUMA an die Berentzen-Gruppe

Die Konsolidierung im Markt für funktionale Getränke setzt sich fort: die 2022 gegründete food42morrow GmbH übergibt ihre Marke JUMA im Rahmen eines strategischen Exits an die Vivaris Getränke GmbH & Co. KG, eine Tochtergesellschaft der börsennotierten Berentzen-Gruppe Aktiengesellschaft. Ab Mai 2026 soll die großflächige Skalierung unter der Flagge von Vivaris als JUMA Recharge+ erfolgen.

Die food42morrow GmbH wurde 2022 in Frankfurt am Main mit dem Ziel gegründet, Marktlücken im Bereich Functional Food durch wissenschaftlich fundierte und trendorientierte Konzepte zu schließen. Die Gründer Raoul Kammann, Max Kammann und Carlos Lopez Granado entwickelten mit JUMA eine Antwort auf die steigende Nachfrage nach natürlichen Wachmachern.

Das Kernprodukt RECHARGE+ ist ein teebasierter Hydration Drink, der Elektrolyte, Vitamine und natürliches Koffein (u. a. aus Guayusa) kombiniert. Der Fokus liegt hierbei auf einer Funktionalität ohne Zuckerzusatz, die speziell auf die Bedürfnisse einer urbanen, aktiven Zielgruppe zugeschnitten ist. Bereits 2025 konnte das Start-up die Marktfähigkeit durch erste Listungen im deutschen Lebensmitteleinzelhandel (LEH) nachweisen.

Packaging-Innovation als strategischer Hebel

Ein wesentliches Alleinstellungsmerkmal, das den Exit maßgeblich begünstigt haben dürfte, ist das innovative Gebinde. food42morrow brachte als erstes Unternehmen in Deutschland eine wiederverschließbare Aluminiumflasche mit Schraubverschluss in dieser Kategorie auf den Markt. Diese Verpackung kombiniert die hohe Recyclingquote von Aluminium mit der Flexibilität einer Flasche. Für etablierte Konzerne wie die Berentzen-Gruppe stellt eine solche bereits validierte „Hardware-Innovation“ einen hohen Wert dar, da sie das Risiko bei der Markteinführung neuer Kategorien senkt.

Einordnung: Die „Evolve 2030“-Strategie

Der Zukauf durch die Berentzen-Gruppe ist kein Zufall, sondern Teil einer breiteren Branchenbewegung. Mit der Strategie BERENTZEN EVOLVE 2030 reagiert der Konzern auf den rückläufigen Spirituosenkonsum und investiert massiv in das Segment der alkoholfreien Getränke (AfG). JUMA fungiert hierbei als Portfolio-Ergänzung im margenstarken Premium-Bereich der funktionalen Drinks. Ähnliche Strategien verfolgten zuletzt auch Akteure wie Eckes-Granini oder die Paulaner-Gruppe bei der Integration agiler Innovationsmarken.

Key Learnings für Gründer*innen

Aus dem Case food42morrow lassen sich drei zentrale Erkenntnisse für die Skalierung von Konsumgüter-Start-ups ableiten:

- USP durch Packaging: In einem gesättigten Markt reicht ein guter Inhalt oft nicht aus. Eine technologische oder funktionale Innovation bei der Verpackung kann der entscheidende Türöffner für den LEH und für Akquisitionsgespräche sein.

- Validierung vor Skalierung: Der Exit erfolgte erst, nachdem die Marktfähigkeit (Proof of Market) durch erste Listungen 2025 bewiesen war. Große Player kaufen bevorzugt Marken, die ihre „Kinderkrankheiten“ bereits überwunden haben.

- Positionierung als „Brückenbauer“: food42morrow hat sich erfolgreich als Bindeglied zwischen Start-up-Agilität und industrieller Skalierung positioniert. Dies ermöglicht es den Gründern, sich auf ihre Kernkompetenz – die Produktentwicklung – zu konzentrieren, während die massive Distribution durch die Strukturen eines Konzerns erfolgt.

Was kommt nach JUMA?

Mit der Übergabe der Marke an Vivaris stellt food42morrow seine Kompetenz als Innovationstaktgeber unter Beweis. Bleibt die spannende Frage, welche Trends das Frankfurter Team als Nächstes identifiziert.

meinhaus.digital sammelt eine Mio. Euro für die Sanierungswende ein

Ein „KI-Architekt“, der Renovierungen von Bestandsimmobilien deutlich günstiger und schneller machen soll: Das PropTech meinhaus.digital hat eine Pre-Seed-Finanzierungsrunde in Höhe von einer Million Euro abgeschlossen.

Das von Leonie Dowling, Carolin Krebber und Ina Schröder gegründete PropTech-Start-up meinhaus.digital GmbH mit Sitz in Schwäbisch Gmünd und München hat frisches Kapital in Höhe von einer Million Euro eingesammelt. Angesichts eines Marktes für energetische Gebäudesanierung in Deutschland, in den laut dem Deutschen Institut für Wirtschaftsforschung jährlich über 70 Milliarden Euro fließen, verdeutlicht diese Investition das hohe Interesse an digitalen Lösungen für die Bau- und Immobilienbranche. Getragen wird die Finanzierungsrunde von der L-Bank Baden-Württemberg sowie Business Angels aus Stuttgart und München, zu denen auch der Start-up-Investor Martin Giese gehört.

Der Blick ins Register: Neustart statt Neugründung

Hinter meinhaus.digital stehen die drei Gründerinnen Leonie Dowling, Carolin Krebber und Ina Schröder, wobei Dowling und Krebber als Co-CEOs agieren. Ein Blick ins Handelsregister zeigt: Die rechtliche Keimzelle des Start-ups wurde von Dowling bereits 2021 unter dem Namen Palasts GmbH gegründet. Das Jahr 2025 markiert hingegen den operativen Neustart unter dem heutigen Namen meinhaus.digital sowie die Formierung des aktuellen Gründerinnen-Trios. Ungeachtet dieser Vorgeschichte ist das personelle Wachstum beachtlich. Seit 2025 wuchs das Team von drei auf zwölf Mitarbeiterinnen und Mitarbeiter an. Bis Ende 2026 soll die Belegschaft auf rund 30 Personen aufgestockt werden, wobei der Fokus stark auf den Bereichen Technologie, Vertrieb und Marketing liegt.

KI statt Architekt: Kampfpreis und OBI-Deal

Das Start-up positioniert sich als digitaler Planer für Umbau- und Sanierungsprojekte bei Bestandsimmobilien. Die Plattform kombiniert dafür eine KI-gestützte Software mit dem Fachwissen von echten Architektinnen, Architekten sowie der Energieberatung. Das Ziel ist es, Hauskäufer*innen und Eigentümer*innen eine transparente Maßnahmen-, Kosten- und Finanzierungsplanung aus einer Hand zu liefern. Das Versprechen der Gründerinnen, Planungsleistungen bis zu 70 Prozent günstiger und bis zu zehnmal schneller als klassische Architektenleistungen anzubieten, ist dabei eine klare Kampfansage an die traditionelle Zunft.

Um dieses Modell rasant in den Markt zu drücken, nutzt meinhaus.digital strategische B2B2C-Partnerschaften. Eine Kooperation mit der Baumarktkette OBI läuft bereits und soll die digitale Maßnahmenplanung mit der Umsetzungskompetenz des Marktes verknüpfen. Weitere Pilotprojekte mit Branchengrößen wie Check24, Wüstenrot und Schwäbisch Hall stehen kurz vor dem Roll-out. Damit soll der Kund*innenstamm von aktuell über 100 auf mehr als 4.000 skalieren, um langfristig den Umsatz bis 2027 zu verzehnfachen. Der Bedarf ist da, denn die reale Sanierungsquote hinkt den Klimazielen massiv hinterher, da Planungsleistungen für viele schlichtweg zu aufwendig und zu teuer sind.

Reality-Check: Kommt die Software gegen den Altbau an?

Doch die Vision vom digitalen Architekten muss sich in der harten Realität des deutschen Altbaubestandes erst noch dauerhaft beweisen. Jede Bestandsimmobilie bringt individuelle statische, bauphysikalische und rechtliche Tücken mit sich. Ob die hybride Lösung aus Software und menschlicher Expertise die Nuancen eines verbauten Altbaus lückenlos und fehlerfrei erfassen kann, muss sich in der Praxis zeigen. Auch das Versprechen, signifikant günstiger zu sein, birgt Risiken in puncto Profitabilität. Dies erfordert radikal standardisierte Prozesse im Hintergrund, um als VC-finanziertes Start-up dauerhaft profitable Margen zu erwirtschaften.

Hinzu kommt eine massive Konkurrenz. Der PropTech-Sektor ist heiß umkämpft und gut finanziert. Schwergewichte wie das Berliner Start-up Enter oder Fuchs & Eule positionieren sich bereits extrem stark und mit massivem Werbedruck im Bereich der digitalen Energieberatung, 3D-Modellierung und Fördermittelbeantragung. Das junge Team aus München und Schwäbisch Gmünd muss nun beweisen, dass die architektonische Tiefe ihres Produkts einen echten Burggraben gegenüber der reinen Energieberatung der Wettbewerber bildet.

Fazit: Smartes Playbook, harter Stresstest

Für die Start-up-Community liefert meinhaus.digital ein brillantes Playbook in Sachen Go-to-Market-Strategie. Anstatt das frische Kapital in teures, umkämpftes Endkund*innen-Marketing zu verbrennen, setzt das Team konsequent auf den B2B2C-Kanal. Die Integration in die etablierte Customer Journey von Playern wie OBI oder großen Bausparkassen ist ein top Hebel, um die Kund*innenakquisitionskosten drastisch zu senken und sich Vertrauen bei den Endkund*innen zu leihen.

deeplify sammelt 2 Mio. Euro für digitalisierte Inspektionen von Pipelines, Chemieanlagen und Brücken

Das 2023 von Jan Löwer, Christoph Siemer und Felix Asanger gegründete Bochumer Industrial-AI-Start-up deeplify bringt frischen Wind in die analog geprägte und sicherheitskritische Anlagenprüfung.

Die Überwachung von Pipelines, Chemieanlagen und Brücken unterliegt strengsten Sicherheitsvorgaben. Die sogenannte zerstörungsfreie Prüfung (ZfP / NDT) – beispielsweise mittels Ultraschall oder Röntgen – wird traditionell von zertifizierten Prüfer*innen durchgeführt. Die Dokumentation und Auswertung dieser Daten ist in der Regel zeitaufwendig und stark analog geprägt. An dieser Schnittstelle positioniert sich die 2023 gegründete deeplify GmbH aus Bochum. Das Start-up entwickelt KI-Software für sicherheitskritische Inspektionen in Energie, Chemie und Industrie. Die angebotene Software-Plattform soll Aufgabenmanagement, eine KI-gestützte Defektanalyse sowie die Berichtserstellung in einem System bündeln.

Vom Agenturgeschäft zur SaaS-Lösung

Die Idee zu deeplify entstand 2022 aus einer Data-Science-Agentur heraus. Das heutige Führungsteam setzt sich aus drei Personen mit unterschiedlichen fachlichen Schwerpunkten zusammen. CEO Jan Löwer, ein studierter Physiker und vormaliger Gründer besagter Agentur, verantwortet die strategische Ausrichtung des Unternehmens. Die operativen Prozesse steuert Christoph Siemer (COO), der zuvor über zehn Jahre als Manager beim Energiekonzern BP tätig war – eine Branchenerfahrung, die dem Start-up den vertrieblichen Zugang zur Schwerindustrie erleichtern soll. Die technische Entwicklung leitet der Robotik- und Kognitionsexperte Felix Asanger (CTO).

Auf die Frage, woran das anfängliche Agenturmodell im spezifischen Markt gescheitert sei, stellt CEO Jan Löwer klar: „Gescheitert ist das Agenturmodell nicht. Es hat funktioniert und Umsatz gebracht.“ Es sei jedoch auf einen breiteren Markt industrieller Anwendungen ausgelegt gewesen. Den Wechsel zum reinen Software-as-a-Service (SaaS)-Produkt erklärt der Gründer mit dem klaren Blick auf Marktchancen: „Wir haben dabei gesehen, dass im SaaS-Produkt das deutlich größere Skalierungspotenzial liegt.“ Der Pivot sei eine bewusste strategische Entscheidung gewesen, fügt Löwer hinzu: „Wir haben uns gefragt, wo wir den größten Hebel haben und die Antwort war eindeutig.“

Plattformansatz für Inspektionsdaten

Mit dem Produkt „deeplify inspect“ verfolgt das Unternehmen das Ziel, die oft fragmentierten Prüfdaten verschiedener Hardware-Hersteller*innen in einer DICONDE-kompatiblen Datenbank zu zentralisieren. Darauf aufbauend sollen KI-Algorithmen die Inspektor*innen bei der Fehlererkennung unterstützen. Das SaaS-Modell verspricht eine Standardisierung der Qualitätssicherung sowie eine Reduktion der Auswertungskosten. Laut Unternehmensangaben konnte deeplify bereits erste Kund*innen im Energiesektor gewinnen. Dazu zählt unter anderem der Fernleitungsnetzbetreiber Open Grid Europe (OGE), mit dem im Zuge von Transformationsprojekten Datensätze zusammengeführt wurden. Zudem gibt es Kooperationen mit Inspektionsunternehmen.

Die Schwerindustrie gilt als konservativ, und Hardware-Hersteller setzen oft auf eigene Software-Silos. Löwer sieht darin jedoch keine unüberwindbare Hürde: „Vendor-Lock-ins sind in der Anlagenprüfung weniger ausgeprägt. Betreiber setzen mehrere Hardware-Lösungen parallel ein und legen Wert auf Unabhängigkeit.“ Deeplify positioniere sich exakt an diesem Punkt: „Als herstellerunabhängige Plattform integrieren wir Inspektionsdaten aus bestehenden Systemen über standardisierte Schnittstellen und überführen sie in ein offenes Format“, betont der Gründer.

Das Versprechen an die Industrie formuliert er deutlich: „Die Unternehmen behalten ihre Hardware, wir schaffen auf der Datenebene zentrale Verfügbarkeit, Vergleichbarkeit und KI-gestützte Auswertung.“ Um die Lösung auch für Konzerne wie OGE wirtschaftlich attraktiv zu machen, verzichtet deeplify beim Pricing bewusst auf große Upfront-Investments. Löwer skizziert das Modell: „Unternehmen starten mit einer Testphase und geringen Einstiegshürden, der Funktionsumfang skaliert modular mit dem tatsächlichen Bedarf.“

Marktumfeld & regulatorische Barrieren

Der Markt für Asset-Integrity-Management wächst, bedingt durch eine alternde europäische Infrastruktur und einen zunehmenden Mangel an qualifiziertem Prüfpersonal. Gleichzeitig sind die Markteintrittsbarrieren extrem hoch. In sicherheitskritischen Bereichen gelten strenge Zertifizierungsvorgaben, und die Haftungsrisiken bei übersehenen Defekten sind immens.

Um die regulatorischen Hürden zu umgehen, positioniert deeplify seine KI nicht als autonomen Prüfer, sondern wählt einen „Human-in-the-loop“-Ansatz. Die Software assistiert, die finale rechtliche Verantwortung und Entscheidungsgewalt verbleibt bei den menschlichen Prüferinnen. Auf das Risiko angesprochen, dass Prüferinnen sich zunehmend blind auf die KI verlassen könnten (Automation Bias), kontert Löwer: „Unser Ziel ist nicht, den Prüfer zu ersetzen, sondern seine Entscheidungsqualität messbar zu stärken.“ Er bezeichnet den Human-in-the-loop-Ansatz als „bewusstes Designprinzip“. Die KI sei primär als Assistenzsystem konzipiert: „Sie macht Vorschläge transparent, weist Unsicherheiten aus und liefert nachvollziehbare Entscheidungsgrundlagen“, so der CEO. Er versichert zudem, dass bestehende Prüfprozesse, Normen und Vier-Augen-Prinzipien vollständig erhalten blieben.

Auch das Training der KI-Modelle erfordert den Zugang zu hochspezifischen, oft vertraulichen Datensätzen der Anlagenbetreiber*innen. Löwer erklärt die Beschaffung dieser sensiblen Daten: „Beim Thema Trainingsdaten setzen wir auf enge Partnerschaften mit Anlagenbetreibern, die uns bereits für Entwicklung und Validierung reale Prüfdaten zur Verfügung stellen.“ Das ermögliche praxisnahes Training und stelle sicher, „dass unsere Modelle unter realen Bedingungen zuverlässig arbeiten“.

Der technologische Burggraben im starken Wettbewerb

Der NDT-Softwaremarkt ist stark fragmentiert und zunehmend umkämpft. Auf der einen Seite stehen internationale Start-ups und Scale-ups wie HUVRdata oder Abyss Solutions sowie Tech-Spezialisten wie Screening Eagle. Auf der anderen Seite rüsten etablierte NDT-Riesen wie Waygate Technologies ihre Systeme mit KI-Komponenten aus, während Prüfkonzerne wie TÜV oder SGS signifikant in Digitalisierungseinheiten investieren.

Deeplify muss beweisen, dass der herstellerunabhängige SaaS-Ansatz diesen teils proprietären Systemen überlegen ist. Globale Konzerne und Hardware-Marktführer sitzen auf riesigen historischen Datenbergen. Auf die Frage nach dem tatsächlichen technologischen Burggraben (Moat) gegenüber etablierten Playern stellt Löwer einen grundlegenden Besitzanspruch klar: „Der entscheidende Punkt ist: Die Daten gehören den Anlagenbetreibern, nicht den Hardware-Herstellern“. Deeplify positioniere sich als herstellerunabhängige Daten- und KI-Schicht, „die systemübergreifend integriert und erstmals echte Interoperabilität in der Anlagenprüfung schafft“.

Den eigenen Wettbewerbsvorteil definiert Löwer sehr spezifisch: „Unser Moat liegt in der Kombination aus tiefem NDT- und Asset-Integrity-Know-how mit spezialisierten, proprietären KI-Modellen, die direkt auf Rohdatenebene arbeiten.“ Der Gründer übt in diesem Zusammenhang auch Kritik am Status quo der Branche: „Viele etablierte Anbieter sind in ihren eigenen Ökosystemen gefangen und können diese Perspektive kaum abbilden.“ Durch Projekte und Partnerschaften baue deeplify kontinuierlich einen praxisnahen Datenkontext auf, „der nicht als Silo funktioniert, sondern als lernende, interoperable Plattform wächst“, schließt Löwer.

Finanzierung & Ausblick

Zur Finanzierung des weiteren Wachstums schließt deeplify nun offiziell eine Pre-Seed-Runde über 2 Mio. Euro ab. Lead-Investor ist D11Z Ventures. Außerdem beteiligen sich Vanagon Ventures, EWOR und strategische Business Angels. Mit dem frischen Kapital will deeplify die technische Infrastruktur der Plattform ausbauen und weitere Einführungen bei Kund*innen in Europa beschleunigen.

Trotz der Wurzeln im Ruhrgebiet sucht das Start-up für die Entwicklung von sogenannter Agentic AI laut öffentlichen Hiring-Daten nun Personal am Standort München. Löwer begründet diese Entscheidung mit den ambitionierten Zielen des Unternehmens: „Deeplify ist auf einem Wachstumskurs. Wir benötigen die besten Talente für unser Team.“ Die Wahl des neuen Standorts sei folgerichtig: „München ist eine bewusste strategische Entscheidung. Die Stadt bietet Zugang zu einem der stärksten KI-Talentpools in Europa, ein dichtes Ökosystem aus DeepTech-Unternehmen und Forschungseinrichtungen sowie die Nähe zu potenziellen Industriekunden."

cuisyn schließt Finanzierungsrunde ab und startet Gastro-Roll-up im Rhein-Main-Gebiet

Das Frankfurter Start-up cuisyn hat sich frisches Kapital gesichert und übernimmt auf einen Schlag sieben Traditionsbetriebe. Nun soll das Modell auf die Individualgastronomie übertragen werden. Eine spannende Wette auf Skaleneffekte im Hintergrund – doch lässt sich der Charme eines Einzelrestaurants wirklich in ein Konzernkorsett pressen?

Das von der blueworld.group gegründete Gastronomie-Unternehmen cuisyn hat eine neue Finanzierungsrunde abgeschlossen. Als neuer strategischer Investor steigt die Beteiligungsgesellschaft Summiteer ein, die von Ex-Akasol-CEO Sven Schulz gegründet wurde und von Geschäftsführer Dominik Bär geleitet wird.

Mit dem frischen Kapital (über die Höhe wurden keine Angaben veröffentlicht) beschleunigt cuisyn seine Buy-and-Build-Strategie massiv und verkündet die Übernahme von sieben weiteren Betrieben im Rhein-Main-Gebiet. Konkret handelt es sich dabei um:

- das IZU Asian Bistro,

- das Hotel und Restaurant Paulaner am Dom,

- die Oberschweinstiege,

- die Zur Käsmühle,

- sowie die Lokale Paulaner und Little Italy im Gebäude THE SQUAIRE.

Durch diese gezielten Zukäufe verdreifacht die Gruppe ihren Umsatz im Vergleich zum Vorjahr und plant bereits die nächste Expansionsphase in weitere deutsche Städte.

Team & Gründungshistorie

Hinter der im Jahr 2021 gegründeten Dachgesellschaft Mutti freut sich GmbH steht eine Mischung aus Serial Entrepreneuren und Gastro-Veteranen. Dr. Rigbert Fischer, der als Gründer und Geschäftsführer agiert, bringt die Blaupause für das Geschäftsmodell mit: Mit seiner blueworld.group formte er bereits das „Haus der Bäcker“ durch gezielte Nachfolgelösungen zu einer schlagkräftigen Gruppe.

Markus Langkamm steuert als weiterer Geschäftsführer die operative Branchenexpertise bei, nachdem er zuvor zahlreiche Konzepte für die renommierte Gekko Group entwickelte und führte. Ergänzt wird das Führungsteam unter anderem durch Matthias Kapaun (Process Development), ehemals Managing Director bei GO by Steffen Henssler, sowie durch die HR-Managerin Hannah Issing.

Die Front bleibt individuell, das Backend wird Systemgastro

Der Kernansatz von cuisyn ist es, erfolgreiche, individuelle Gastronomiebetriebe zu kaufen und deren Einzigartigkeit, Werte und Historie zu erhalten. Dem Gast soll im Restaurant nicht auffallen, dass er sich in einem stark systematisierten Filialbetrieb befindet.

Das Versprechen an die übernommenen Betriebe lautet, die Individualgastronomie zukunftsfähig zu machen, indem die Stärken der Systemgastronomie im Hintergrund genutzt werden. Während sich die Teams vor Ort auf die Kernkompetenzen Service und Küche fokussieren, zentralisiert und digitalisiert cuisyn die sekundären Prozesse. Dazu gehören:

- Digitale Systeme und IT,

- Finanzen und Controlling,

- Marketing und Employer Branding,

- Personalbeschaffung,

- Qualitätsmanagement und HACCP,

- Einkauf und Wareneinsatz.

Kritische Einordnung für das Start-up-Ökosystem

Das Vorhaben von cuisyn wirft aus operativer Sicht kritische Fragen auf, die über Erfolg oder Scheitern der Plattform entscheiden werden. Ein zentraler Punkt sind die Grenzen der Synergieeffekte: Anders als beim „Haus der Bäcker“, wo zentrale Großbäckereien standardisierte Teiglinge liefern können, sind die kulinarischen Konzepte bei cuisyn extrem heterogen. Ein asiatisches Bistro hat gänzlich andere Einkaufsbedürfnisse als ein gutbürgerliches Wirtshaus. Die versprochenen Synergien im Zentraleinkauf dürften daher bei den Rohwaren weitaus geringer ausfallen als in der klassischen Systemgastronomie. Skaleneffekte beschränken sich primär auf sekundäre Betriebsprozesse wie IT und Personalwesen.

Hinzu kommt der sogenannte „Wirt-Faktor“. Die Seele eines erfolgreichen Individualbetriebs ist oft der Gründer oder Inhaber. Ein Buy-and-Build-Modell muss beweisen, dass die emotionale Bindung der Stammgäste nicht abreißt, wenn der Fokus auf standardisierten Systemen im Hintergrund liegt. cuisyn steht vor der massiven Herausforderung, den Charakter der einzelnen Konzepte nicht zu verlieren, während nachhaltige Strukturen aufgebaut werden.

Fazit

Die Steuerung dieser Komplexität erfordert ein extrem agiles Management. Standardisierung ist der eigentliche Hebel eines Roll-ups – cuisyn muss den perfekten Balanceakt meistern, im Hintergrund effiziente Prozesse zu etablieren, ohne dass die „Front“ ihre Authentizität verliert. Gelingt es dem Team um Dr. Rigbert Fischer jedoch, diesen Beweis anzutreten, könnte cuisyn in den kommenden Jahren zu einer führenden Plattform in der deutschen Gastronomielandschaft heranwachsen.

Vom Solinger Start-up zum globalen Einhorn: Wie Dash0 die Observability-Giganten dekonstruiert

Das 2023 gegründete KI-Start-up Dash0 hat im März 2026 mit einer 110-Millionen-Dollar-Runde die magische Milliardenbewertung geknackt. Die Vision: Die Systemüberwachung von Software durch offene Standards, radikal faire Preismodelle und pragmatische KI zu revolutionieren. Doch der Frontalangriff auf US-Goliaths wie Datadog birgt strategische Risiken.

In der modernen Softwareentwicklung ertrinken IT-Teams in einer Flut aus Warnmeldungen, Logs und Metriken. Klassische Überwachungs-Tools (Observability) sind oft teuer, komplex und sperren Kunden in geschlossene Daten-Ökosysteme ein. Genau dieses Problem adressiert Dash0 – und hat damit in Rekordzeit Investoren und namhafte Kunden überzeugt. „Systemüberwachung ist heute kaputt: Sie ist zu laut, zu teuer und zu komplex“, bringt es Dash0-CEO und Mitgründer Mirko Novakovic auf den Punkt.

Die Gründer und der rasante Aufstieg zum Einhorn

Hinter Dash0 steht ein Quintett erfahrener Tech-Veteranen. Besonders Mirko Novakovic ist in der B2B-Szene ein Schwergewicht: 2020 verkaufte er sein vorheriges Start-up Instana für rund 500 Millionen US-Dollar an IBM. Dieser „Repeat Founder“-Status erklärt das enorme Vertrauen der Geldgeber.

Die Historie von Dash0 liest sich wie ein Start-up-Märchen im Zeitraffer: Nach der Gründung 2023 im nordrhein-westfälischen Solingen folgte Ende 2024 eine 9,5-Millionen-Dollar-Seed-Runde parallel zum Produktlaunch. Ein Jahr später sammelte das Team 35 Millionen Dollar ein.

Der Ritterschlag folgte nun im März 2026: Mit einer von Balderton Capital angeführten Series-B-Runde über 110 Millionen Dollar steigt Dash0 in den Kreis der Unicorns auf. Diesen Meilenstein verknüpft das Team mit einer klaren Kampfansage: „Mit den 110 Millionen Dollar, die wir heute bekannt geben, bringen wir autonome Abläufe zu jedem Entwicklerteam der Welt – noch bevor unsere Wettbewerber überhaupt begreifen, was mit ihnen geschieht.“

Das Produkt: Ein Frontalangriff auf die Industrie-Norm

Ein Blick unter die Haube zeigt, warum die Plattform so schnell wächst. Das Start-up dekonstruiert gezielt die Schwachstellen der etablierten Milliardenkonzerne:

- Das Ende des „Vendor Lock-ins“: Dash0 basiert vollständig auf offenen CNCF-Standards (OpenTelemetry). Als Abfragesprache wird nativ PromQL genutzt, für Dashboards kommt das quelloffene Perses zum Einsatz. Das bedeutet für Technik-Entscheider: Würde Dash0 die Preise anheben, könnten sie ihre gesamten Dashboards und Alarme einfach mitnehmen und woanders hosten.

- Radikales Pricing: Branchenriesen rechnen oft nach Datenvolumen (Gigabyte) oder Nutzerlizenzen ab, was bei wachsenden Systemen zu explodierenden Budgets führt. Dash0 rechnet rein nach der Anzahl der gesendeten Telemetrie-Datenpunkte ab. Unternehmen können unlimitiert Metadaten anhängen und unbegrenzt viele Entwickler auf das System lassen, ohne dass verdeckte Kosten anfallen.

- Developer Experience (DX): Dash0 positioniert sich als Tool „von Ingenieuren für Ingenieure“. Die Plattform lässt sich für maximale Geschwindigkeit komplett per Tastatur steuern, und Konfigurationen können nahtlos als Code (Configuration as Code) in bestehende Entwicklungs-Pipelines integriert werden.