Aktuelle Events

Diese Unis bringen die erfolgreichsten Exit-Gründer*innen hervor

Eine Untersuchung der knapp 400 Exits im Jahr 2024 hat viele spannende Ergebnisse ans Licht gefördert: WHU nicht mehr top; LMU führt; Informatik schlägt BWL. Hier gibt's alle Fakten.

Im Jahr 2024 haben die Gründer*innen von insgesamt 396 deutschen Unternehmen einen Exit vollzogen. Doch wo haben diese erfolgreichen Gründer*innen studiert? Welche Fachrichtungen sind besonders stark vertreten und welchen Abschluss haben sie erworben? Eine aktuelle Analyse des Webhosting-Anbieters Hostinger zeigt, dass 2024 die Otto Beisheim School of Management (WHU) nicht wie in den Jahren zuvor an der Spitze des Exit-Uni-Rankings steht.

Für die Untersuchung wurden alle in den Medien erfassten Exits des Jahres 2024 berücksichtigt. Weitere Details zu den Gründer*innen wurden durch Recherche auf Social-Media-Seiten und Unternehmenswebseiten ermittelt. Es gab jedoch Gründer*innen, denen aufgrund des Fehlens entsprechender Online-Daten weder eine Universität, ein Fachbereich noch ein Abschluss zugeordnet werden konnten.

Süden als Start-up-Schmiede

Die meisten Exit-Gründer*innen des Jahres 2024 kommen aus dem Süden Deutschlands sowie aus Österreich. An der Spitze des Rankings steht die Ludwig-Maximilians-Universität München (LMU), die mit 15 Absolvent*innen die größte Anzahl an Exit-Gründer*innen stellt. Unter anderem konnten Absolventen wie Max Wittrock, Co-Founder mymuesly (Mehrheitsanteilerwerb von Bestandsinvestoren – Katjes Greenfood) und Andreas Budde mit dem App-Analyse-Unternehmen 42matters (Übernahmen durch Similarweb) erfolgreiche Exits feiern. Auf dem zweiten Platz folgt die Technische Universität Wien mit 13 Absolvent*innen und die Technische Universität München, die ebenfalls 13 Absolvent*innen vorweisen kann. Gemeinsam vereinen diese drei renommierten Hochschulen mehr als zehn Prozent aller Exits auf sich. Das Podium schließt die Technische Universität Berlin mit acht Absolvent*innen. Als erste nicht deutschsprachige Universität belegt die ESCP Business School (Berlin) den 16. Platz in dem Ranking und hat vier erfolgreiche Gründer*innen hervorgebracht.

Durchschnittlich weisen die Universitäten eine Absolvent*innenzahl von 2,26 für Exit-Gründer*innen des Jahres 2024 auf. Damit liegen 141 Universitäten der 173 untersuchten Universitäten unter dem Durchschnitt. Universitäten und Hochschulen in Berlin sind mit 20 Absolvent*innen vertreten. Das entspricht einem Anteil von 5,05 Prozent.

Die beliebtesten Studienfächer: Informatik an der Spitze

Das Studienfach Informatik ist der eindeutige Favorit unter den Exit-Gründer*innen 2024. Mit 17 Absolvent*innen führt dieses Fach das Fächer-Ranking an. Diese Absolvent*innen gründeten unter anderem ProDato oder Getsurance. Auf dem zweiten Platz folgt Wirtschaftsinformatik mit zwölf Absolvent*innen. Platz drei geht an den Studiengang Wirtschaft, der neun Absolvent*innen hervorgebracht hat. Insgesamt umfasst das Fächerranking 198 verschiedene Studienfächer, was die Vielfalt der akademischen Hintergründe der Gründer*innen zeigt.

Master-Abschluss als Basis für den Gründungserfolg

Der Master-Abschluss ist deutlich die Nummer 1 unter den Abschlussarten der Exit-Gründer*innen 2024. Mit 130 Absolvent*innen, was 32,83 Prozent der gesamten Gründer*innen ausmacht, stellt der Master-Abschluss mehr als ein Drittel der erfolgreichen Gründer*innen. Darunter befinden sich z.B. auch Ingo Seebach und René Seeber, die mit dem Drohnenabwehrunternehmen Dedrone und dessen Übernahme durch den US-Konzern Axon einen der größten Exits im vergangenen Jahr verzeichneten. Auf dem zweiten Platz folgt der Bachelor-Abschluss mit 55 Absolvent*innen, während der Diplom-Abschluss mit 47 Absolvent*innen den dritten Rang einnimmt. Auch Doktorabschlüsse sind mit 43 Absolvent*innen vertreten. Deutlich weniger verbreitet ist das Staatsexamen auf Platz fünf. Mit sieben Absolvent*innen ist die Differenz zwischen Doktorabschlüssen und Staatsexamen signifikant. Und auch ohne Abschluss ist eine Übernahme möglich: Tarek Müller, Mitgründer von About You, das derzeit in der Übernahme von Zalando steht, gehört zu den erfolgreichen Unternehmern ohne akademischen Abschluss.

Die gesamte Untersuchung inkl. sämtlicher Ergebnisse ist hier zu finden.

Diese Artikel könnten Sie auch interessieren:

Produktivität statt Überstunden: Wie Echtzeitdaten das Finanzwesen von morgen steuern

Das KI-gestützte Fintech Embat beendet das Excel-Chaos im Treasury und macht Finanzteams mit Echtzeitdaten fit für die Zukunft.

Berlin, 28. April 2026 – Es ist ein bekanntes Bild in den Finanz- und Treasury-Abteilungen des deutschen Mittelstands: Wenn der Monatsabschluss naht oder Ad-hoc-Berichte für die Geschäftsführung benötigt werden, bleiben die Schreibtischlampen bis spät in die Nacht an. Die manuelle Zusammenführung von Daten aus unterschiedlichen Bankportalen und historisch gewachsenen Excel-Listen kostet nicht nur Nerven, sondern vor allem wertvolle Zeit.

Das schnell wachsende Fintech Embat tritt an, um genau diesen Engpass aufzulösen. André Reimers, Head of DACH, treibt diese Mission im deutschsprachigen Raum als Gesicht des Unternehmens voran. Seine Kernüberzeugung: Wer heute noch regelmäßig Überstunden machen muss, um finanzielle Transparenz zu schaffen, leidet nicht unter mangelnder Einsatzbereitschaft – er leidet unter einem strukturellen Datenproblem.

Beeindruckendes Wachstum durch das Lösen echter Pain Points

Dass der Schmerz in den Finanzabteilungen groß und der Bedarf an modernen Lösungen riesig ist, belegen die Zahlen, mit denen Embat den europäischen Markt aufrollt. Mit einem starken Kundenwachstum im deutschen Markt von über 250 Prozent im vergangenen Jahr und mittlerweile mehr als 400 mittelständischen und großen Unternehmenskunden weltweit hat sich das Fintech als fester Player etabliert. Das stetig wachsende Transaktionsvolumen von 250 Millionen Euro zeigt deutlich: Der Wechsel von fehleranfälligen Tabellen zu automatisierten Cloud-Lösungen ist in vollem Gange.

Der Weg aus der Excel-Falle

Mit seiner Technologie nimmt Embat den Kampf gegen ineffiziente Prozesse im Treasury auf. Anstatt hochqualifizierte Mitarbeiter mit repetitiver Datenpflege zu binden, automatisiert das System die Konsolidierung aller relevanten Finanzdaten.

„Die Erwartungshaltung, dass komplexe Finanzanalysen zwingend mit langen Abenden im Büro einhergehen müssen, ist schlichtweg nicht mehr zeitgemäß“, erklärt André Reimers. „Wenn Cashflow, Liquidität und Runways per Knopfdruck in Echtzeit abrufbar sind, ändert sich die gesamte Arbeitsdynamik. Finanzteams können aus dem reaktiven Modus heraustreten und sich auf die strategische Steuerung des Unternehmens konzentrieren.“

Hohe Innovationskraft trifft auf lokales DACH-Verständnis

Embat profitiert von einer enormen Innovationsgeschwindigkeit und Agilität, auf der die starke technologische Basis des Unternehmens beruht. Wie diese passgenau auf die spezifischen Bedürfnisse des deutschen Marktes übersetzt wird und für eine hohe lokale Marktpräsenz sorgt, zeigt André Reimers an den Standorten in München und Berlin.

Von diesen beiden Standorten aus steuert André Reimers das DACH-Geschäft und stellt das tiefe Verständnis für die komplexen Strukturen und hohen Sicherheitsbedürfnisse des deutschen Mittelstands sicher. Das Team zeigt dabei, wie moderne, dezentrale Zusammenarbeit erfolgreich funktioniert. Das Vertrauen der stetig wachsenden deutschen Kundenbasis fußt dabei auf dieser geballten lokalen Expertise gepaart mit der unerschütterlichen Zuverlässigkeit der Systeme.

Führen durch Resultate, nicht durch Anwesenheit

Die Botschaft an die Finanzwelt ist klar: Moderne Führung, hohe Produktivität und Skalierbarkeit erfordern keine starren Kontrollmechanismen oder endlosen Arbeitstage. Sie erfordern radikale Datentransparenz und die richtigen digitalen Werkzeuge. Wenn die Daten in Echtzeit fließen, sinkt die Fehlerquote, die Entscheidungsgeschwindigkeit steigt – und die systembedingten Überstunden im Treasury gehören endgültig der Vergangenheit an.

Über Embat:

Embat ist ein KI-gestütztes FinTech mit Schwerpunkt auf Treasury-Management, das es mittelständischen Unternehmen und Großkonzernen ermöglicht, ihre Finanzprozesse in Echtzeit zu zentralisieren. Gegründet von Antonio Berga und Carlos Serrano – ehemaligen J.P. Morgan-Managern mit umfassender Erfahrung im Corporate Banking – sowie Tomás Gil, dem ehemaligen CTO von Fintonic, entstand die Plattform mit der Mission, die Finanzabteilung zu digitalisieren. Die klare Prämisse dabei: Technologie von Finanzexperten für Finanzexperten.

Durch seine hybride Konnektivität lässt sich Embat in über 15.000 Banken und führende ERP-Systeme integrieren und beseitigt so jegliche Datenfragmentierung. Das wichtigste Alleinstellungsmerkmal ist TellMe, ein „Agentic Treasury Analyst“ (autonomer KI-Analyst), der Cashflow-Muster erkennt, komplexe Kontenabstimmungen automatisiert und strategische Entscheidungen zur Optimierung der Liquidität vorschlägt.

Mit Niederlassungen in Madrid, London, Berlin und München definiert Embat die Zukunft des Corporate Finance neu.

ENVIOTECH sichert sich Millionenfinanzierung für intelligente öffentliche Straßenbeleuchtung

Das Frankfurter Start-up ENVIOTECH rund um Adrian Rhaese, Linh Pham, Dustin Arnold und Peter Kletsko hat eine Pre-Seed-Runde in Höhe von einer Million Euro abgeschlossen, um öffentliche Straßenbeleuchtung intelligent nachzurüsten. Doch der Markt für kommunale Infrastruktur ist hart umkämpft und bürokratisch. Kann das junge Team die öffentlichen Verwaltungen überzeugen?

Es ist ein klassisches Gründer*innen-Narrativ: Aus einem persönlichen Schmerzpunkt entsteht eine Geschäftsidee. Im Fall von ENVIOTECH war es ein Fahrradunfall. Der beste Freund von Mitgründer Adrian Rhaese verunglückte, weil in einer deutschen Stadt die Straßenlaternen aufgrund gestiegener Stromkosten abgeschaltet worden waren. Dieser Vorfall weckte bei Rhaese das Unverständnis darüber, dass in einem wirtschaftlich starken Land ausgerechnet an der Sicherheit gespart wird – und legte den Grundstein für das Smart-City-Start-up.

Bye-bye Bankenturm: Der Sprung ins kalte Wasser

Anstatt ihren als sicher geltenden Karriereweg fortzusetzen, verließen Adrian Rhaese und Mitgründerin Linh Pham ihre Positionen als duale Studierende bei der Deutschen Bank. Sie entschieden sich bewusst für das unternehmerische Risiko, um reale Infrastrukturprobleme zu lösen.

Eine erste Bestätigung für diesen Schritt erhielt das junge Team durch die Aufnahme in das EWOR Fellowship. Daniel Dippold, Gründer und CEO von EWOR, bescheinigt dem Team den richtigen Fokus: „Unspektakuläre Infrastruktur gewinnt langfristig fast immer. Straßenbeleuchtung ist nicht glamourös, aber sie ist allgegenwärtig, unverzichtbar und aus keiner Stadt wegzudenken.“

Plug-and-Play am Lichtmast: Das 15-Minuten-Update

Die technische Lösung von ENVIOTECH setzt auf Pragmatismus: Anstatt Laternen kostenintensiv komplett auszutauschen, bietet das Unternehmen ein Retrofit-System an. Das Produkt soll sich laut Unternehmensangaben in unter 15 Minuten in bestehende Leuchten integrieren lassen.

Die nachgerüsteten Laternen kommunizieren als Mesh-Netzwerk miteinander und dimmen das Licht KI-gesteuert und bedarfsgerecht anhand von Bewegungserkennung. Das Startup verspricht dadurch Energieeinsparungen von bis zu 80 Prozent; gleichzeitig soll die öffentliche Sicherheit erhöht werden. Kommunen erhalten so die Möglichkeit, ihre Beleuchtung zentral zu steuern und in Echtzeit zu überwachen.

Um das Konzept in die Fläche zu tragen, konnte ENVIOTECH nun eine Pre-Seed-Finanzierung in Höhe von 1 Million Euro einsammeln. Angeführt wird die Runde passenderweise vom ehemaligen Co-CEO der Deutschen Bank, Jürgen Fitschen. Ergänzt wird das Konsortium durch Ex-MAN-CEO Joachim Drees, Alexander Eyhorn (Gründer von Bidirex) und Danilo Jovicic-Albrecht (Mitgründer des auf Kommunen spezialisierten Startups Vialytics). Mit dem frischen Kapital sollen Pilotprojekte forciert und das Technologieportfolio weiterentwickelt werden.

Der Endgegner heißt B2G-Markt: David gegen die Industrie-Goliaths

So einleuchtend die Technologie klingt, das Geschäftsmodell von ENVIOTECH steht vor gewaltigen Hürden. Der B2G-Markt (Business-to-Government) ist für Start-ups extrem schwierig. Kommunen, die ENVIOTECHs primäre Zielgruppe darstellen, arbeiten mit langen Budgetzyklen und streng regulierten öffentlichen Ausschreibungsverfahren. Bis ein Pilotprojekt zu einem flächendeckenden Rollout führt, vergehen oft Jahre.

Darüber hinaus agiert das Start-up nicht im luftleeren Raum. Der Smart-Lighting-Markt wird von Industriegiganten wie Signify oder Schréder dominiert, die längst eigene IoT-Lichtsteuerungssysteme anbieten. Auch andere Start-ups wie Tvilight oder Icegateway haben das Potenzial vernetzter Straßenbeleuchtung erkannt.

Der entscheidende USP von ENVIOTECH muss daher in der Geschwindigkeit und Einfachheit liegen: Gelingt die versprochene rasante Installation und können Kommunen die Lösung ohne massive Tiefbauarbeiten testen, hat das Start-up einen echten Wettbewerbsvorteil. Besonders klug ist hierbei die Auswahl der Investor*innen: Mit Drees und Jovicic-Albrecht hat das Gründerduo Köpfe an Bord geholt, die wissen, wie man komplexe Produkte an die öffentliche Hand verkauft. Schafft es ENVIOTECH, den extrem zähen Vertriebszyklus öffentlicher Verwaltungen zu knacken, könnte das Unternehmen zu einem hochrentablen Hidden Champion heranwachsen.

Primogene: 4,1 Mio. Euro für den Muttermilch-Code – Deep-Tech-Innovation oder riskantes Unterfangen?

Das Leipziger BioTech-Start-up Primogene hat eine Seed-Finanzierung in Höhe von 4,1 Mio. Euro eingesammelt, um komplexe bioaktive Moleküle im industriellen Maßstab auf den Markt zu bringen.

Während die Unternehmenskommunikation den Durchbruch einer neuen Plattformtechnologie feiert, zeigt ein genauerer Blick auf den globalen Markt für humane Milcholigosaccharide (HMOs) ein Haifischbecken voller multinationaler Konzerne. Eine kritische Analyse des Geschäftsmodells, der Gründer*innen und des Wettbewerbs.

DeepTech Made in Leipzig

Hinter Primogene stehen Dr.-Ing. Reza Mahour (CEO), Valerian Grote und Linda Karger (COO), die das Unternehmen 2023 in Leipzig gründeten. Die Zusammensetzung des Teams vereint technologische und wissenschaftliche Expertise, um die ehrgeizige Vision einer industriellen Enzym-Produktion umzusetzen. Die aktuelle, 4,1 Millionen Euro starke Seed-Runde wird vom High-Tech Gründerfonds (HTGF) angeführt. Zum Investoren-Konsortium gehören außerdem der Technologiegründerfonds Sachsen (TGFS), better ventures, die Sächsische Beteiligungsgesellschaft (SBG), die Golzern Holding GmbH, die FS Life Science Investment GmbH sowie Dr. Marc Struhalla, Gründer und CEO der c-LEcta GmbH. Der Kapitaleinsatz ist klar definiert: Die neuen Mittel fließen in den Ausbau des IP-Portfolios, die Erweiterung der Produktionskapazitäten in Leipzig und in strategische Partnerschaften.

Das Modell im Stresstest: Die Kostenfalle der Enzyme

Primogene hat eine enzymatische Plattformtechnologie entwickelt, um Inhaltsstoffe zu produzieren, die identisch zu natürlichen Molekülen sind – nachhaltig und kosteneffizient. Im Zentrum stehen dabei komplexe humane Milcholigosaccharide (HMOs) wie Disialyllacto-N-Tetraose (DSLNT) und Difucosyllacto-N-Tetraose I (LNDFH I). Laut Primogene verursachen etablierte fermentative Herstellungsverfahren erhebliche Kosten und stoßen bei der Produktion derartiger hochkomplexer Moleküle an ihre Grenzen.

Der Lackmustest: Die Prämisse, dass enzymatische Verfahren in der Massenproduktion überlegen sind, birgt in der Praxis massive Hürden. Die Entwicklung und wirtschaftliche Produktion der benötigten Enzyme selbst ist extrem kapitalintensiv. Dass das Start-up den gesamten Prozess – von der Enzymentwicklung über die Produktion und Biotransformation bis zur Aufreinigung – komplett am eigenen Unternehmensstandort in Leipzig abbilden will, ist ein ambitionierter, aber riskanter Schritt. Der Aufbau eigener Produktionsanlagen für komplexe BioTech-Prozesse führt oft zu einer enorm hohen Kapitalverbrennungsrate (Burn Rate).

Erste kommerzielle Meilensteine dämpfen dieses Risiko jedoch: Erste Inhaltsstoffe für Kosmetikprodukte wurden mit Kooperationspartnern entwickelt und sind bereits kommerziell erhältlich. Auch pharmazeutische Rohstoffe befinden sich aktuell im Test bei Kund*innen. Zudem erforscht das Unternehmen in Zusammenarbeit mit dem Fraunhofer-Institut für Zelltherapie und Immunologie (IZI) in Leipzig das Potenzial seiner Inhaltsstoffe zur Prävention von Infektionskrankheiten.

Im Haifischbecken: Auf Kollisionskurs mit den Lebensmittel-Riesen

Der Zielmarkt ist hochattraktiv: Der globale HMO-Markt wächst jährlich um etwa 18 bis 20 Prozent, und über 65 Prozent der im Jahr 2023 neu eingeführten Säuglingsnahrungsprodukte enthielten mindestens ein HMO. Neben der Säuglingsernährung bedient Primogene auch Märkte wie die Darmgesundheit bei Erwachsenen, die Gedächtnisverbesserung im Alter sowie funktionale Inhaltsstoffe für Körperpflege und pharmazeutische Rohstoffe.

Das Leipziger Team trifft in der Nahrungsmittelindustrie jedoch auf einen extrem konsolidierten Markt, der von Milliarden-Konzernen dominiert wird. Einer der größten B2B-Zulieferer für Säuglingsnahrung weltweit ist DSM-Firmenich (mit der übernommenen Sparte Glycom), der den Markt durch gigantische Größenvorteile (Economies of Scale) in der Fermentation beherrscht. Auch Chr. Hansen (Jennewein), ein Pionier in der mikrobiellen HMO-Synthese, stellt mit seiner extrem tiefen Integration bei Lebensmittelriesen einen massiven Konkurrenten dar. Auf der Abnehmerseite agieren Endkonsument*innen-Giganten und Branchenführer wie Nestlé und Abbott, bei denen für einen neuen Zulieferer von Inhaltsstoffen extrem hohe regulatorische und volumenbasierte Hürden bestehen.

Primogenes strategische Nische: Ein Preiskampf bei einfach strukturierten Standard-HMOs gegen die großen Fermentations-Player wäre für ein Start-up kaum zu gewinnen. Primogenes entscheidender Wettbewerbsvorteil liegt jedoch in der Komplexität. Die industrielle Produktion von Molekülen wie DSLNT – das laut klinischen Studien signifikante gesundheitliche Vorteile speziell für Frühgeborene bietet – war bislang schlicht nicht möglich. Wenn Primogene hier durch sein starkes Patentportfolio die technologische Lücke schließt, umgeht das Unternehmen den harten Konkurrenzkampf im Massenmarkt.

Unser Fazit: Hohes Risiko, riesiger Hebel

Primogene ist kein schlankes Software-Projekt, sondern waschechtes DeepTech. Das bedeutet: Hohe regulatorische Hürden, langer Atem in der Forschung und massive Kapitalanforderungen. Die Seed-Finanzierung in Höhe von 4,1 Millionen Euro ist ein starker Vertrauensbeweis erfahrener Investoren, wird für den Anlagenbau und die Skalierung der Leipziger Produktion auf Dauer jedoch kaum ausreichen. Primogene muss nun rasch beweisen, dass die enzymatische Synthese nicht nur technologisch überlegen, sondern auch unter realen industriellen Kostendrücken skalierbar ist. Gelingt dieser Proof of Concept, hält das Start-up den Schlüssel zu einer neuen Generation komplexer, bioaktiver Moleküle in der Hand.

Cyber-Souveränität als Geschäftsmodell: QuoIntelligence sichert sich 7,3 Mio. Euro für den europäischen Markt

Regulierung als Wachstumstreiber: Das Frankfurter Cyber-Security-Start-up QuoIntelligence sammelt in seiner Series-A-Finanzierungsrunde 7,3 Millionen Euro ein. Das Versprechen: Hochwertige, fertig analysierte Cyber-Bedrohungsdaten speziell für den europäischen Mittelstand. Doch wie skalierbar ist der Spagat zwischen KI-Automatisierung und menschlicher Analyse, wenn man gegen etablierte US-Giganten antritt?

Der Weg von QuoIntelligence ist eng mit der Biografie seines Gründers Marco Riccardi verknüpft. Riccardi verbrachte sieben Jahre tief im IT-Sicherheitsapparat des Frankfurter Finanzsektors: Von 2013 bis 2015 war er als IT-Security-Berater für die Europäische Zentralbank (EZB) tätig, gefolgt von zwei Jahren als Threat Intelligence Analyst bei der Deutschen Bank. Vor der Gründung von QuoIntelligence Anfang 2020 leitete er zudem die Intelligence Operations beim Frankfurter Unternehmen QuoScient.

Heute führt Riccardi das Start-up mit einem europäisch aufgestellten Management-Team, dem unter anderem David Brown (UK), Antonio Arias Lopez (Deutschland), Odín Rodríguez Lago (Spanien) und Marina Gómez Lara (Spanien) angehören.

„Finished Intelligence“ statt roher Daten-Feeds

QuoIntelligence positioniert sich als Anbieter für „Unified Risk Intelligence“. Das Kernproblem vieler Unternehmen: Der Aufbau eines eigenen Cyber-Intelligence-Teams erfordert oft sechsstellige Investitionen allein für Fachpersonal. QuoIntelligence verspricht hier Abhilfe durch „Finished Threat Intelligence“ – fertig analysierte und kontextualisierte Bedrohungsinformationen, die innerhalb weniger Stunden einsatzbereit sind, ohne dass der Kunde ein eigenes internes Expertenteam benötigt.

Technologisch stützt sich das Unternehmen dabei auf zwei Säulen:

- Mercury: Die hauseigene Plattform aggregiert Erkenntnisse aus über 1.000 Quellen und nutzt eine kuratierte Wissensbasis von über 17.000 geprüften Intelligence-Tickets.

- KARLA: Ein konversationeller KI-Analyst soll diese komplexen Informationen für alle Unternehmensebenen – vom Vorstand bis zum Sicherheitsanalysten – zugänglich machen.

Das Modell stößt auf eine beachtliche Marktresonanz: Für das Jahr 2025 meldet das Startup keinen einzigen Kundenabgang (Zero Client Churn). Zudem hat sich der Customer Lifetime Value seit 2023 beinahe versechsfacht. Ein weiterer Vertrauensbeweis ist die Rolle als offizieller ENISA-Anbieter mit einem Vierjahresvertrag über 1,4 Millionen Euro seit Februar 2025.

Der Wachstumsmotor: NIS2, DORA und Daten-Souveränität

Die aktuelle Finanzierungsrunde wird von Elevator Ventures (Raiffeisen Bank International) angeführt und von der BMH Beteiligungs-Managementgesellschaft Hessen co-geführt. Beteiligt sind zudem eCAPITAL und Mercurius Private Equity. Dass hier vor allem Kapital mit starken Wurzeln im Finanzsektor fließt, ist strategisch logisch.

Der entscheidende Markttreiber sind die EU-Richtlinien NIS2 und DORA. Allein NIS2 erfasst europaweit über 160.000 Organisationen – davon über 30.000 in Deutschland – und führt zur persönlichen Haftung der Geschäftsführung bei Versäumnissen. Gleichzeitig fordern europäische Beschaffungsrahmen zunehmend, dass sensible Daten innerhalb der EU verbleiben. Hier zieht QuoIntelligence seinen entscheidenden Burggraben:

- Das Unternehmen ist nach deutschem Recht gegründet.

- Sämtliche Intelligence-Daten werden auf deutschem Boden unter EU-Recht gespeichert.

Die Herausforderungen

Trotz der strategisch klugen Positionierung gibt es Hürden:

- Skalierbarkeit: Das Modell setzt auf einen „Analyst-first“-Ansatz, bei dem Experten jede Information prüfen. Bei massivem Wachstum durch neue Vertriebskanäle muss die KI KARLA beweisen, dass sie diese Expert*innen effizient entlasten kann.

- Globale Konkurrenz: US-Schwergewichte wie CrowdStrike oder Mandiant verfügen über weit größere globale Daten-Netzwerke. QuoIntelligence setzt hier voll auf den Trumpf der „europäischen Souveränität“, um sich abzugrenzen.

- Mittelstands-Trägheit: Ob der Mittelstand über die reine Compliance-Erfüllung hinaus tatsächlich in tiefgehende Risiko-Intelligence investiert, wird das langfristige Wachstumstempo bestimmen.

Unser Fazit

QuoIntelligence zeigt sehr anschaulich, wie man Regulierung (NIS2/DORA) als stärksten Vertriebskanal nutzt. Die Wahl der Investor*innen aus dem Finanzsektor sichert den Zugang zur Kernzielgruppe. Mit der klaren Kante beim Datenschutz („Made in Germany“) besetzt das Start-up eine Nische, die für regulierte Unternehmen in Europa zur Pflicht wird. Gelingt der Spagat zwischen menschlicher Expertise und technischer Skalierung, könnte Frankfurt hier einen dauerhaften Champion der europäischen Cybersicherheit hervorbringen.

Vom Assekuradeur zum Cyber-Abwehrzentrum: Baobabs riskante Wette auf die All-in-One-Lösung

Es ist ein mutiger Schritt für ein junges Unternehmen: Das 2021 in Berlin gegründete InsurTech Baobab Insurance streift sein reines Versicherungs-Image ab und firmiert ab sofort unter dem Namen Baobab Risk Solutions (BRS). Zeitgleich führt das Start-up einen eigenen Managed Detection and Response (MDR) Service ein. Damit will das Unternehmen künftig nicht mehr nur den finanziellen Schaden bei Cyberangriffen abfedern, sondern die Angriffe selbst aktiv abwehren. Ein ambitionierter Plan, der das Geschäftsmodell unter enormen Leistungsdruck setzt.

„Unser neuer Name ist ein Versprechen an den Markt: Wir bieten keine bloßen Policen, sondern eine ganzheitliche Strategie gegen digitale Risiken“, erklärt Mitgründer und Geschäftsführer Vincenz Klemm. Prävention, Abwehr und Versicherung sollen fortan eine untrennbare Einheit bilden. Auf die Vermutung, das reine Versicherungsgeschäft sei für den Mittelstand schlichtweg zu unprofitabel geworden, kontert der Gründer deutlich: „Der Wechsel zu Risk Solutions ist weit mehr als ein neues Branding. Damit lösen wir unser Gründungsversprechen konsequent ein.“ Die bloße Police sei nie das Endprodukt gewesen, der Schritt zum aktiven Abwehrdienstleister sei von Tag eins an auf der Roadmap gestanden. Klemm fasst die neue Ausrichtung in einem klaren Kernsatz zusammen: „Wir warten somit nicht darauf, dass ein Schaden reguliert werden muss. Wir sorgen stattdessen aktiv dafür, dass er gar nicht erst entsteht.“ Dies sei kein Ausstieg aus der Versicherung, sondern die Evolution zum echten Risikomanagement für den Mittelstand und Industrieunternehmen.

Vom Millionen-Exit zum Cyber-Schutzschild

Um die Ambitionen von Baobab Risk Solutions zu verstehen, lohnt ein Blick auf das Gründer-Duo. Vincenz Klemm (Geschäftsführer) und Anton Foth (CTO) bringen geballte Erfahrung mit. Klemm baute in den USA den digitalen Makler Gabi auf und verkaufte ihn für rund 320 Millionen US-Dollar an Experian, während Foth als ehemaliger CTO von Coya (später Luko) die tiefe technische Expertise für datengetriebene Versicherungsmodelle liefert. Gestartet mit rund 4,2 Millionen US-Dollar Pre-Seed-Kapital, ist das Unternehmen mittlerweile in Deutschland, Österreich und den Benelux-Ländern aktiv.

Der Aufbau eines europäischen Assekuradeurs in den vergangenen fünf Jahren verlief dabei nicht ohne Hürden. „Eine europäische Expansion ist niemals eine reine Blaupause“, räumt Klemm ein. Um regulatorische Fallstricke frühzeitig zu erkennen, setze man gezielt auf lokale Expertise wie den General Manager für die Benelux-Staaten, Tim van Lier. Als größten Trumpf sieht Klemm jedoch die eigene Reaktionsgeschwindigkeit: „Wenn etwas nicht funktioniert, korrigieren wir es binnen Tagen, statt in monatelangen Release-Zyklen zu verharren.“ Auch die Frage nach frischem Kapital für den nun extrem kostenintensiven MDR-Betrieb wischt er routiniert beiseite: Man sei durch die letzte Finanzierungsrunde hervorragend aufgestellt. Sollte man dennoch nachlegen müssen, wisse man Investoren an der Seite, die „bei positiven Trends extrem schnell Kapital mobilisieren können.“

Der neue Vorstoß: MDR und ein 24/7-Defense-Center

Die Argumente für den neuen, zubuchbaren MDR-Service stützen sich auf drastische Marktveränderungen. Laut dem CrowdStrike Global Threat Report 2026 erfolgen 82 Prozent aller Angriffe mittlerweile ohne klassische Schadsoftware, woran Standard-Antivirus-Programme oft scheitern. Baobabs Antwort darauf ist ein rund um die Uhr besetztes Security Operations Center (SOC). Die Ansagen des Start-ups sind selbstbewusst: Mit einer Erkennungsrate von 99 Prozent identifiziere man Bedrohungen bereits in der Entstehungsphase. Die hauseigene Deep-Scan-Technologie arbeite 3,2-mal effektiver als herkömmliche Scans, zudem liege die Angriffsfrequenz bei Bestandskund*innen um 77 Prozent unter dem Marktdurchschnitt. Ergänzt wird das Ganze durch Dark Web Monitoring.

Doch wie kann ein Start-up im Angesicht des globalen Fachkräftemangels in der Cybersecurity personell und technologisch mit staatlich finanzierten Hacker-Syndikaten mithalten? Klemm verweist auf das ambitionierte Umfeld: Weil das Team Kunden aktiv berate und nicht nur stumpf Risiken überwache, habe man sich als Top-Adresse für Talente etabliert. Gleichzeitig gibt er sich pragmatisch und räumt ein, dass man nicht alles allein stemmen kann: „Um personelle Spitzen abzufangen, kooperieren wir mit hochprofessionellen Technologiepartnern.“ Diese Hybridstrategie sichere die Skalierbarkeit und den Zugang zu führender Technologie. Das absolute Kernversprechen an den Kunden tastet er dabei jedoch nicht an: „Die Analyse und der direkte Kontakt bleiben immer bei uns.“

Genial verzahnt oder überhoben?

In der Theorie ist die Verknüpfung von aktiver Abwehr und Versicherung genial: Versagen die Abwehrmaßnahmen von Baobab, muss die Versicherung den finanziellen Schaden ohnehin tragen – die Interessen von Kund*in und Versicherer sind maximal synchronisiert. In der Praxis gleicht der Betrieb eines 24/7-SOC jedoch einem Hochseilakt, der extrem personal- und kostenintensiv ist. Zudem droht ein massives Klumpenrisiko, falls ein neuartiger Zero-Day-Exploit die Filterlogik umgeht und hunderte Mittelständlerinnen gleichzeitig kompromittiert werden.

Auf dieses „All-Eggs-in-One-Basket“-Szenario angesprochen, reagiert Klemm unaufgeregt und verweist auf die harten Realitäten der Branche: „In der Cybersecurity gibt es keine hundertprozentige Sicherheit. Daher stellt ein neuartiger Zero-Day-Exploit für die gesamte Branche grundsätzlich ein Kumulrisiko dar.“ Doch genau dieses Risiko trage man als Assekuradeur über die Policen ohnehin bereits. Der MDR-Service sei kein zusätzliches Risiko, sondern ein Schutzschild. „Anstatt die Gefahr zu vergrößern, reduziert unsere aktive Abwehr die Wahrscheinlichkeit, dass ein solches Ereignis überhaupt zum Tragen kommt“, argumentiert der Geschäftsführer. Und wenn alle Stricke reißen? „Die Versicherungspolice ist der finale Sicherheitsanker für den reinen Risikotransfer“, stellt er klar.

Markt & Wettbewerb: Kampf der Titanen

Im Mid-Market-Segment tritt das Berliner Team gegen globale Giganten wie Munich Re oder spezialisierte Cyber-MGAs wie das US-Einhorn Coalition an. Auch der Markteintritt US-amerikanischer Riesen in Europa beunruhigt Klemm nicht – im Gegenteil: „Der Markteintritt globaler Akteure unterstreicht vor allem eines: Das enorme Potenzial des europäischen Cybermarktes.“

Die Marschroute für die kommenden 12 bis 18 Monate ist klar gesteckt. Man wolle die Verzahnung von Vorfallsreaktion (Incident Response) und MDR weiter vertiefen und die Schadenquote weiter unter den Marktdurchschnitt drücken. Der entscheidende Hebel soll jedoch die Radikalvereinfachung des Versicherungsabschlusses werden. „Unser Ziel: Der Abschluss einer Cyberversicherung oder Vertrauensschadenversicherung muss so einfach werden wie nie zuvor – für Makler und Kunden“, verspricht Klemm. Gegen die übermächtige Konkurrenz will er nicht durch schiere Finanzkraft gewinnen: „Wir gewinnen diesen Wettbewerb nicht über das größte Marketingbudget, sondern über das beste Risikomanagement und die engste Partnerschaft mit dem Mittelstand.“

Für die Branche ist Baobab damit ein spannendes Lehrstück über die Vertikalisierung von Geschäftsmodellen. Schaffen es die Berliner, ihr technologisches Versprechen zu halten, bauen sie eine hochprofitable Cybersecurity-Festung für den europäischen Mittelstand. Scheitert die Technik jedoch an der Realität komplexer Cyberbedrohungen, droht das gesamte Modell unter den eigenen Schadensquoten zu kollabieren. Es bleibt ein riskantes, aber zukunftsweisendes Play.

Spritgeld für den Start-up-Motor: PR-Stunt oder genialer Dealflow-Generator? Der neue „GründerTank“ von Christopher Obereder im Check

Reisekosten, Tankrechnungen und Bahntickets sind für junge Bootstrapping-Start-ups oft schmerzhafte Posten. Der Münchner Investor und Ex-Silicon-Valley-Macher Christopher Obereder will mit einer neuen privaten Initiative für Start-ups in Deutschland genau hier ansetzen. Ein Gesamtbudget von bis zu 100.000 Euro steht für betriebliche Mobilitätskosten bereit. Doch hinter der pragmatischen Fördermittel-Story verbirgt sich ein überaus cleveres Geschäftsmodell zur Startup-Akquise. Eine Einordnung.

Wer den GründerTank verstehen will, muss zunächst auf seinen Initiator blicken. Christopher Obereder, in der Szene oft schlicht Startup-Chris genannt, ist kein Unbekannter. Bereits 2017 landete er als 26-Jähriger auf der renommierten „Forbes 30 Under 30“-Liste. Im Silicon Valley erarbeitete er sich einen Ruf als Experte für virales Marketing. Mit Exits und Engagements bei Hit-Apps wie Tellonym baute er sich finanzielles Gewicht auf. Durch medienwirksame Formate, wie die von ihm initiierte Bayern 3 Startup Challenge, brachte er das Thema Start-up-Finanzierung einem breiten Publikum nahe. Heute leitet er von Taufkirchen aus die Start-up-Chris Ventures GmbH und investiert gezielt in junge Tech-Unternehmen.

Spritgeld statt Folien-Bingo

Mit dem GründerTank, der von Unicorn AI unterstützt wird, ruft Obereder nun eine konkrete Mobilitätsförderung ins Leben. Der Fokus liegt dabei nicht auf schönen Präsentationen, sondern auf der harten operativen Realität. Unterstützt werden können je nach Einzelfall unter anderem Kraftstoffkosten für geschäftliche Fahrten, ÖPNV-Tickets, Carsharing oder Reisen zu Messen und Investoren.

Obereders Argumentation ist bestechend pragmatisch: „Wir tanken nicht nur Autos. Wir helfen Gründerinnen und Gründern, in Bewegung zu bleiben“, erklärt der Investor. „Viele Programme sprechen über Innovation. Mich interessiert, ob Gründer wirklich unterwegs sind, Kunden treffen, Feedback einsammeln und Momentum aufbauen. [...] Wenn Bewegung im Alltag ein echter Hebel ist, soll sie nicht an ein paar Rechnungen scheitern.“

Erstes gefördertes Start-up dieser Initiative ist Kluuu, eine innovative Lernplattform, die es Studierenden ermöglicht, ihren Lernstoff in interaktive Quizze umzuwandeln. Deren Vertreter Leon Sean Brown bestätigt den Schmerzpunkt vieler Start-ups: „Die Tankpreise sind hoch, operative Wege kosten Zeit und Geld, und genau dort entsteht oft der nächste Wachstumsschritt.“ Gerade in der frühen Phase zähle jeder Euro.

Der wahre Motor: Dealflow zum Discount-Tarif

Liest man die Ankündigung, wirkt das Projekt sehr wohlwollend. Doch bei genauerer Betrachtung erweist sich der GründerTank als strategisches Meisterstück der Dealflow-Generierung für Obereders Investmentvehikel.

- Geringer Kapitaleinsatz, maximaler Einblick: Die ausgelobten 100.000 Euro sind ein Gesamtbudget. Im Gegenzug für die Chance auf die Übernahme von Zugtickets oder Tankrechnungen reichen unzählige Start-ups ihre Unterlagen und Traktionsdaten ein. Für einen professionellen Investor ist dies ein unschlagbar kostengünstiger Weg, um an hochqualitative, topaktuelle Unternehmensdaten der umtriebigsten Frühphasen-Gründer*innen des Landes zu gelangen. Reguläre Venture-Capital-Fonds geben für das Scouting ein Vielfaches dieses Budgets aus.

- Skalierung durch künstliche Intelligenz: Die Flut an Bewerbungen wird nicht mühsam per Hand sortiert. Die eingereichten Unterlagen werden zunächst KI-gestützt vorbewertet. Die KI dient ausschließlich der Vorbewertung und Priorisierung, bevor am Ende Menschen die finale Auswahl treffen.

- Exzellentes PR-Narrativ: Die Story positioniert Obereder als echten „Hands-on“-Macher und adressiert ein spürbares Problem. Ein Rechtsanspruch auf Teilnahme oder Förderung besteht dabei ausdrücklich nicht, weshalb das finanzielle Risiko für den Initiator absolut gedeckelt ist.

Fazit: Mitfahren, aber smart

Sollten junge Unternehmerinnen und Unternehmer beim GründerTank mitmachen? Die Antwort lautet: Ja, aber mit strategischem Bewusstsein. Für Bootstrapping-Teams bietet das Programm eine unkomplizierte Hilfe. Wer den Zuschlag erhält, gewinnt nicht nur finanzielle Beinfreiheit, sondern landet unweigerlich auf dem Radar eines bestens vernetzten Investors.

Gründer*innen müssen sich jedoch des Tauschgeschäfts bewusst sein: Sie gewähren tiefe Einblicke in ihr Geschäftsmodell, um im Gegenzug potenziell Mobilitätskosten erstattet zu bekommen. Man sollte das Programm daher weniger als reine Spendenaktion betrachten, sondern vielmehr als das, was es im Kern ist: Einer der innovativsten und kosteneffizientesten Start-up-Scouting-Funnel der aktuellen Szene.

11 Mio. USD für VisioLab: Stürzt ein Osnabrücker Start-up die Kassen-Dinos?

Das Start-up VisioLab der Gründer an Tim Niekamp und Iwo Gernemann hat den Kassen-Dinos den Kampf angesagt, in dem es den Checkout in Mensen und Arenen durch simple iPad-KI automatisiert.

In der Systemgastronomie, in Mensen und Stadien ist der größte Engpass oft nicht die Küche, sondern die Kasse. Das Osnabrücker Start-up VisioLab adressiert dieses Problem mit künstlicher Intelligenz und verwandelt handelsübliche iPads in voll funktionsfähige Self-Checkout-Systeme. Für die weitere globale Skalierung hat das Unternehmen nun eine Series-A-Finanzierung in Höhe von 11 Millionen US-Dollar abgeschlossen. Angeführt wird die Runde von eCAPITAL Entrepreneurial Partners und Simon Capital, unterstützt von bestehenden Investor*innen wie dem High-Tech Gründerfonds, APX, dem Family Office zwei.7 und Business Angels wie Jens Ohr. Doch wie robust ist dieses scheinbar simple Geschäftsmodell im hart umkämpften Markt der Kassenautomatisierung wirklich?

Aus der Mensa in die NBA: Die Köpfe hinter dem Kassen-Killer

Gegründet wurde VisioLab im Jahr 2019 in Osnabrück von CEO Tim Niekamp und President & COO Iwo Gernemann. Die Idee entsprang einem stark spürbaren Schmerzpunkt in der Gastronomie: Zur Mittagszeit oder in der Halbzeitpause stauen sich die Gäste, während herkömmliche Kassensysteme oft im fünfstelligen Preisbereich liegen und aufwendig geschultes Personal erfordern. Zudem verschärft der chronische Personalmangel in der Foodservice-Branche die Lage massiv.

Die Vision der Gründer war von Beginn an, den Checkout-Prozess durch KI so drastisch zu vereinfachen, dass die zugrundeliegende Technologie im Betrieb kaum noch als solche wahrgenommen wird. Mit einem aktuellen Team von rund 25 Mitarbeitern an den Standorten Osnabrück und Boston haben Niekamp und Gernemann das System iterativ zur Marktreife geführt und internationalisiert. Das frische Kapital soll nun genutzt werden, um das Team auf etwa 40 Mitarbeiter auszubauen – gezielt verstärkt durch ehemalige Führungskräfte von Klarna, SumUp und Google.

Ein iPad als Kassensystem: Geniestreich oder Achillesferse?

Die technische Umsetzung besticht durch Hardware-Minimalismus. VisioLab eliminiert teure, proprietäre Scanner-Kassen und setzt stattdessen auf ein Apple iPad samt Kamera, kombiniert mit einem kompakten Bluetooth-Bezahlterminal und der eigenen KI-App. Die KI erkennt Speisen und Getränke auf dem Tablett in Echtzeit – unabhängig davon, ob diese verpackt oder lose sind. VisioLab vertreibt dieses Setup als "Plug-and-Play"-Lösung direkt als E-Commerce-Produkt über einen Online-Shop. Ein einziges Foto genügt laut Unternehmensangaben, um der KI ein neues Produkt beizubringen, wodurch das System in weniger als fünf Minuten startklar sein soll.

Die fundamentalen Zahlen belegen, dass diese Strategie derzeit voll aufgeht:

- Transaktionen: Weltweit verarbeiten rund 500 Installationen etwa eine Million Transaktionen im Monat.

- Gesamtvolumen: Das kumulierte Transaktionsvolumen liegt mittlerweile bei knapp 100 Millionen US-Dollar.

- Wirtschaftlichkeit: Im vergangenen Quartal verzeichnete das Unternehmen erstmals einen positiven Cashflow.

Kritisch hinterfragt

Der Verzicht auf stark spezialisierte Hardware ist ein zweischneidiges Schwert. Einerseits ermöglicht es VisioLab eine enorme Vertriebsgeschwindigkeit ohne große Hardware-Vorfinanzierungen und langwierige Installationen. Andererseits ist die rein kamerabasierte 2D-Erkennung auf einem handelsüblichen Tablet potenziell anfällig für komplexe Lichtverhältnisse oder optisch nahezu identische Gerichte. Zudem begibt sich das Start-up in eine absolute Abhängigkeit vom Apple-Ökosystem. Das Geschäftsmodell erfordert eine konstante technologische Weiterentwicklung, um die "Churn-Rate" (Kund*innenabwanderung) gering zu halten, da die Wechselkosten für Gastronom*innen bei einer reinen iPad-Lösung verhältnismäßig niedrig sind.

Der Kampf um die Food-Erkennung

Der globale Markt für "AI Food Recognition" und Self-Checkout erlebt derzeit einen massiven Schub. VisioLab hat sich in diesem Umfeld geschickt in lukrativen, hochfrequentierten Nischen positioniert:

- Sport & Entertainment: In den USA stattet VisioLab beispielsweise die Arena des NBA-Teams Orlando Magic mit 43 Systemen aus und deckt damit fast das gesamte Stadion ab. Weitere Kunden sind die NFL-Teams Atlanta Falcons und Carolina Panthers sowie der Fußballclub Inter Miami.

- Bildung & Corporate: Etwa jeder dritte deutsche Uni-Campus nutzt die Technologie über die Studierendenwerke. Hinzu kommen Betriebskantinen von DAX-Konzernen und Kooperationen mit globalen Caterern wie der Compass Group und Aramark.

Allerdings agiert VisioLab nicht konkurrenzlos. Der Wettbewerb ist technologisch divers und hochkapitalisiert. Das US-Start-up Mashgin gilt als einer der härtesten globalen Konkurrenten. Im Gegensatz zu VisioLab setzt Mashgin auf spezielle Kiosk-Terminals mit multiplen 3D-Kameras. Das erhöht zwar die Hardwarekosten und den Installationsaufwand drastisch, verspricht aber eine extrem hohe Erkennungsgenauigkeit selbst bei chaotischen Objektanordnungen. Auch auf dem Heimatmarkt gibt es mit Start-ups wie auvisus ("VisionCheckout") starke Wettbewerber*innen, die ebenfalls KI-Bilderkennung für Betriebsrestaurants und Kantinen anbieten.

Fazit: Hyperwachstum mit Haken

Für die Start-up-Szene liefert VisioLab ein beeindruckendes Beispiel dafür, wie kluges "Go-to-Market"-Design aussieht. Anstatt den kapitalintensiven Weg proprietärer Hardware-Entwicklung zu gehen, nutzt das Team Standard-Consumer-Hardware und fokussiert die gesamte Wertschöpfung auf die smarte KI-Software am Endgerät.

Diese agile Entscheidung ermöglicht das derzeitige Hyperwachstum: Das US-Geschäft steuert bereits rund 50 Prozent zum Umsatz bei und wächst jährlich um über 1.000 Prozent. Mit dem frischen Kapital, dem Ausbau des US-Standorts durch Co-Founder Iwo Gernemann sowie der gezielten Expansion nach Australien, Neuseeland, Österreich, Großbritannien und in die Niederlande stellt VisioLab die Weichen auf globale Skalierung.

Ob das Osnabrücker Start-up langfristig gegen bestens finanzierte US-Giganten und 3D-Kamera-Spezialisten bestehen kann, wird sich an der Robustheit der Software im massenhaften Dauerbetrieb zeigen. Gelingt es VisioLab, durch kontinuierliches KI-Training seinen Genauigkeits- und "Plug-and-Play"-Vorteil auszubauen, hat das Team hervorragende Chancen, den Checkout-Prozess in der Systemgastronomie dauerhaft zu dominieren.

Schluss mit Kaskodenken: Was der neue Innovationsrat Gründer*innen bringt

Pünktlich zur Hannover Messe formiert sich ein neues Schwergewicht in der deutschen Technologiepolitik: Acht Expertinnen und Experten haben den ehrenamtlichen „Innovationsrat für Deutschland“ ins Leben gerufen. Getragen von der VDI-Initiative „Zukunft Deutschland 2050“ und der Gesellschaft für Informatik (GI) bündelt das Gremium die Stimmen von über 160.000 Ingenieur*innen und Informatiker*innen.

Die Diagnose des Rats fällt drastisch aus: Deutschland verliere im globalen Wettbewerb an Verbindlichkeit und Umsetzungsgeschwindigkeit. Für die Gründer*ionnenszene birgt das Manifest vielversprechende Forderungen – es stellt sich jedoch auch die Frage, ob ein weiteres Gremium die strukturelle Risikoaversion des Standorts durchbrechen kann.

Das Kernproblem: Erfunden in Deutschland, skaliert im Ausland?

Das zentrale Narrativ des Innovationsrats trifft einen wunden Punkt der heimischen Start-up-Ökonomie: Es dürfe nicht länger passieren, dass Schlüsseltechnologien zwar in deutschen Forschungslaboren erfunden, aber aufgrund fehlenden Kapitals oder restriktiver Regulierung im Ausland skaliert werden. Der Rat fordert in seinen „5 Impulsen“ eine fundamentale Neuausrichtung:

- Schluss mit dem Legislaturperioden-Takt: Innovationspolitik muss langfristig und faktenbasiert gedacht werden, nicht in kurzatmigen Wahlzyklen.

- Regulierung als Enabler statt als Bremse: Die Expert*innen fordern den Abbau von europäischem „Goldplating“ (der innovationsfeindlichen Übererfüllung von EU-Normen durch nationale Gesetze) und die Schaffung echter Experimentierräume und Reallabore.

- Mut statt „Kaskodenken“: Anstatt risikoscheu zu agieren, müssen strategische Investitionen in Schlüsseltechnologien fließen. Die Rahmenbedingungen für Scale-ups müssen massiv verbessert werden, um industrielles Skalieren im eigenen Land zu ermöglichen.

Die Köpfe hinter dem Innovationsrat für Deutschland

Die Zusammensetzung des Gremiums unterstreicht den Anspruch, Technologie, Recht und Wirtschaft zusammenzudenken:

- Prof. Dr. Lutz Eckstein: VDI-Präsident und Experte für automatisiertes Fahren an der RWTH Aachen.

- Prof. Dr. Veronika Grimm: Professorin an der TU Nürnberg und als „Wirtschaftsweise“ eine der prägendsten Stimmen der Energiepolitik.

- Prof. Dietmar Harhoff, PhD: Direktor am Max-Planck-Institut für Innovation und Wettbewerb sowie langjähriger EFI-Vorsitzender.

- Prof. Dr. Jürgen Kühling: Regulierungs- und Wettbewerbsexperte sowie ehemaliger Vorsitzender der Monopolkommission.

- Dr. Anne Lamp: Gründerin und Pionierin im Bereich Circular Economy.

- Dr. Melanie Maas-Brunner: Industrielle Forschungsexpertin, ehemalige BASF-Vorständin und designierte Präsidentin des Stifterverbands.

- Adrian Willig: Direktor des VDI mit Fokus auf Ingenieurkompetenzen und Technikstandort-Förderung.

- Prof. Dr. Martin Wolf: Präsident der Gesellschaft für Informatik und Experte für intelligente Produktionssysteme.

Im Start-up-Fokus: Dr. Anne Lamp und der harte Weg der Skalierung

Dass der Innovationsrat nicht nur aus der wissenschaftlichen Helikopterperspektive agiert, zeigt eine entscheidende Personalie: Dr. Anne Lamp sitzt am Tisch. Die CEO und Mitgründerin des Hamburger Start-ups traceless materials steht wie kaum eine andere für die Herausforderungen der industriellen Kreislaufwirtschaft.

Im Jahr 2020 ins Leben gerufen, hat traceless ein vollständig biobasiertes Granulat aus Agrar-Reststoffen entwickelt, das als Alternative zu Plastik dient und unter natürlichen Bedingungen in nur zwei bis neun Wochen kompostierbar ist. Lamp, 2022 mit dem Deutschen Gründerpreis ausgezeichnet und 2025 für den Deutschen Zukunftspreis nominiert, hat ihr Unternehmen erfolgreich aus dem Labor geholt. Mit der Realisierung einer groß angelegten Demonstrationsanlage hat das Start-up das für Hardware-Gründungen berüchtigte „Tal des Todes“ gemeistert. Mit der geplanten Industrieanlage soll die Kapazität künftig um ein Vielfaches gesteigert und das Material massentauglich gemacht werden. Lamps Vita verkörpert exakt das, was der Rat nun auf politischer Ebene einfordert: Die erfolgreiche Überführung nachhaltiger Technologien von der Erfindung in die marktfähige, industrielle Skalierung.

Unsere Einordnung: Ein weiteres Gremium oder echter Hebel?

Die entscheidende Frage für Gründer*innen und Start-ups bleibt: Bewirkt dieser Rat wirklich etwas? An technologiepolitischen Beiräten mangelt es der Bundesrepublik traditionell nicht. So sitzt mit Prof. Dietmar Harhoff bezeichnenderweise der langjährige Vorsitzende der bereits existierenden Expertenkommission Forschung und Innovation (EFI) der Bundesregierung ebenfalls in diesem neuen Gremium.

Dennoch hat der Innovationsrat zwei strategische Vorteile: Er ist explizit unabhängig von Parteien und Einzelinteressen der Wirtschaft und vereint mit dem VDI und der GI die geballte Umsetzungskompetenz der technischen Basis. Die Visionen sind ambitioniert – etwa die Forderung, vertrauenswürdige KI als „Trained in Germany“ zu einem neuen globalen Gütesiegel aufzubauen.

Für Deep-Tech- und Hardware-Start-ups wird der Rat jedoch nicht an der bloßen Anzahl seiner künftigen Stellungnahmen gemessen werden, sondern daran, ob seine Impulse tatsächlich in den Maschinenraum der Politik vordringen. Erst wenn das geforderte Kapital für die Wachstumsphase fließt und Genehmigungsverfahren radikal entschlackt werden, wird das „Kaskodenken“ wirklich der Vergangenheit angehören.

Synera sichert sich 35 Mio. Euro für die Revolution des Engineerings

Was einst als bionisches Forschungsprojekt begann, ist heute eine der vielversprechendsten europäischen DeepTech-Hoffnungen. Doch wie tragfähig ist die Vision vom „autonomen digitalen Ingenieur“ im stark regulierten Maschinenbau? Ein tieferer Blick auf Gründer, Markt und das Geschäftsmodell.

Die deutsche Industrie steht unter massivem Druck: Internationale Konkurrenz – insbesondere aus Asien –, chronischer Fachkräftemangel und die Notwendigkeit, Entwicklungszyklen drastisch zu verkürzen, zwingen zum Handeln. Generative künstliche Intelligenz (GenAI) gilt als Heilsbringer, doch in der Praxis verpuffen viele Initiativen. Nur etwa 41 Prozent der KI-Prototypen in der Fertigungsindustrie erreichen laut Branchenstudien den produktiven Einsatz. Die Konstruktions- und Entwicklungsabteilungen gelten als stark in Silos organisiert und bis heute schwer automatisierbar.

„Engineering ist das Rückgrat jedes Industrieunternehmens, gehört jedoch nach wie vor zu den am wenigsten digitalisierten und automatisierten Funktionen und war bis vor Kurzem für KI weitgehend unzugänglich“, bringt es Dr. Moritz Maier, Co-CEO von Synera, auf den Punkt.

Genau in diese Lücke stößt sein Unternehmen. Mit einer Series-B-Finanzierungsrunde über 35 Millionen Euro will das Bremer Startup nun international skalieren. Angeführt wird die Runde vom europäischen Wachstumsfonds Revaia, mit starker Beteiligung des UVC Partners Wachstumsfonds sowie Capgemini (über ISAI Cap Ventures). Auch die Bestandsinvestoren Spark Capital, BMW iVentures und Cherry Ventures ziehen wieder mit. Das Signal an den Markt ist deutlich: Engineering Automation wird zum nächsten großen Software-Schlachtfeld.

Von Kieselalgen zur KI-Plattform

Hinter Synera stehen die Gründer Moritz Maier, Daniel Siegel (beide Co-CEO) und Sebastian Möller (Managing Director). Die Ursprungsidee entstand am renommierten Alfred-Wegener-Institut (AWI) in Bremerhaven. Die Gründer forschten dort im Bereich der Bionik und untersuchten die Leichtbaustrukturen von Kieselalgen, um deren evolutionäre Prinzipien auf technische Bauteile zu übertragen.

Aus „Evolutionary Light Structure Engineering“ wurde 2018 die Ausgründung ELISE. Zunächst lag der Fokus auf algorithmusbasiertem Design. Mit der Zeit erkannten die Gründer jedoch ein viel grundlegenderes Problem: Es fehlte nicht an Software für das eigentliche Design, sondern an einer Brücke, die die unzähligen Insellösungen (CAD, Simulation, Materialprüfung) im Engineering-Alltag verbindet. Dies führte zur Neuausrichtung und schließlich zur Umbenennung in Synera – einer Low-Code- und KI-Plattform für Connected Engineering.

Das Geschäftsmodell im Check

Synera betreibt ein klassisches B2B-Plattform-Modell. Anstatt etablierte Platzhirsche im Computer-Aided Design (CAD) zu verdrängen, positioniert sich Synera als übergeordnete Orchestrierungsschicht. Die Software klinkt sich in über 80 bestehende Tools ein.

- Der Werttreiber: Nutzer*innen können komplexe Workflows (z. B. CAD-Modellierung → Simulation → Kostenkalkulation → Designanpassung) als Templates speichern. Das frische Kapital soll laut Moritz Maier nun eine Entwicklung beschleunigen, „bei der KI-Agenten als echte digitale Engineers agieren und komplexe Workflows entlang der gesamten Wertschöpfungskette autonom ausführen.“

- Der Lock-in-Effekt: Wenn ein Industriekonzern seine Kernprozesse auf Synera automatisiert hat, ist die Plattform kaum noch auszutauschen. Die Wechselkosten für den Kunden sind enorm.

- Die Herausforderungen: Das Modell ist technisch hochkomplex. Die ständige Pflege von über 80 API-Schnittstellen zu Drittanbietern bindet gewaltige Entwickler*innen-Ressourcen. Zudem erfordert der Vertrieb in klassische Hardware-Unternehmen lange Sales-Zyklen.

Zwischen RPA und Spezial-CAD

Wettbewerbsumfeld | Marktansatz | Syneras Differenzierung |

Generatives Design (z. B. nTop, Altair) | Fokus auf die Erstellung hochkomplexer, gewichtsoptimierter Bauteile. | Synera generiert nicht nur das Design, sondern automatisiert den Prozess quer durch verschiedene externe Tools. |

Klassische RPA (z. B. UiPath, Zapier) | Hervorragend für kaufmännische Prozesse (HR, CRM, Rechnungen). | Standard-RPA scheitert an den komplexen 3D-Geometrie- und Physikdaten des Engineerings. |

PLM-Systeme (z. B. Siemens, Dassault) | Verwalten den gesamten Produktlebenszyklus und die Daten. | Synera setzt sich auf diese oft schwerfälligen Systeme, um die agilen Arbeitsschritte flexibler zu machen. |

Kritische Einordnung: Vertraut der/die Ingenieur*in der KI?

Synera verweist auf eine Umsatzverdopplung im vergangenen Jahr und über 60 namhafte Kunden, darunter BMW, Airbus, NASA und Miele. Mit dem frischen Kapital steht die Expansion nach Asien, Europa und in die USA an. Dass dieser Wachstumskurs von den Investoren aktiv gestützt wird, betont Benjamin Erhart, General Partner bei UVC Partners: „Wir konnten erleben, wie Synera als zuverlässiger Partner die Transformation des Engineerings gestaltet.“

Doch der Weg zur breiten Durchdringung birgt auch Stolpersteine:

- Das Vertrauensproblem: „Agentic AI“ bedeutet, dass die Software eigenständig Entscheidungen trifft. In sicherheitskritischen Branchen (Luftfahrt, Automotive) herrschen jedoch strikte Compliance-Regeln. Bevor ein KI-Agent autonome Designänderungen an tragenden Bauteilen vornimmt, müssen massive Haftungsfragen geklärt sein.

- Die Pilot-Falle: Viele GenAI-Projekte scheitern auf dem Weg in die Produktion. Die Gefahr für Synera besteht darin, in Innovationsabteilungen stecken zu bleiben, während das operative Kerngeschäft aus Kostengründen an bewährten Methoden festhält.

- Die API-Abhängigkeit: Wer als Brückenbauer*in zwischen Dutzenden Software-Silos agiert, macht sich von den Anbietern abhängig. Sperrt ein großer CAD-Anbieter seine API, trifft dies Syneras Modell im Kern.

Fazit

Synera ist ein exzellentes Beispiel dafür, wie aus akademischer Grundlagenforschung ein hoch skalierbares DeepTech-Produkt werden kann. Der strategische Pivot vom reinen Design-Tool zur prozessübergreifenden Plattform zahlt sich durch die starke Series B nun aus. Gelingt es den Bremern, den eher konservativen globalen Maschinenbau davon zu überzeugen, dass KI-Agenten die menschlichen Ingenieur*innen nicht ersetzen, sondern befähigen, könnte Synera der entscheidende globale Standard im Connected Engineering werden.

Gründer*in der Woche: Little World – Spracherwerb durch echte Begegnung

Wie Oliver Berlin mit seinem Aachener Social-Start-up Little World trotz beachtlichen Erfolgs vor der großen Herausforderung der Anschlussfinanzierung steht – und was das über ein strukturelles Defizit in unserem Fördersystem verrät.

Es ist eine dieser Geschichten, die eigentlich ein Happy End haben müssten. Die Zahlen stimmen, die gesellschaftliche Wirkung ist messbar, und die Menschen sind begeistert. Doch Oliver Berlin, Wirtschaftsingenieur und Gründer des Social-Start-ups Little World, blickt derzeit nicht auf Erfolgsstatistiken, sondern auf ein finanzielles Problem. Sein Projekt offenbart ein strukturelles Defizit in unserem Fördersystem und steht vor einer massiven Herausforderung, da eine essenzielle Förderung Ende 2025 ausgelaufen ist.

Spracherwerb durch echte Begegnung

Die Vision von Little World ist so simpel wie effektiv: Menschen, die Deutsch sprechen, treffen sich im digitalen Raum mit Menschen, die Deutsch lernen. Es geht dabei nicht um klassische Nachhilfe oder sture Grammatik, sondern um echten Austausch auf Augenhöhe über den Alltag, Hobbys und die Familie.

Auslöser für die Gründung war Berlins eigene Erfahrung während der Pandemie, als er beobachtete, wie seine Mutter täglich ältere Menschen anrief, um ihnen Gesellschaft zu leisten. Zusammen mit Tim Schupp und Sean Blundell fusionierte er 2022 diese Idee zu Little World. Der Erfolg ließ nicht lange auf sich warten. Innerhalb der ersten drei Monate nach dem Launch verzeichnete die Plattform bereits 1.000 Anmeldungen. Heute vernetzt das Start-up bundesweit rund 6.500 Menschen und vermittelt jährlich etwa 1.200 Gesprächspaare.

Wie die Community über sich hinauswächst

Dass Little World weit mehr ist als eine reine Vermittlungsmaschine, zeigt sich daran, wie sich das Angebot mittlerweile organisch aus der Community heraus weiterentwickelt. Neben den 1-zu-1-Gesprächen gibt es inzwischen auch von den Teilnehmenden selbst initiierte Gruppenformate, wie etwa den neuen Online-Buchclub.

Ins Leben gerufen wurde dieser von der 27-jährigen Varvara, die selbst erst seit Anfang 2025 als Deutschlernende auf der Plattform aktiv ist. Ihr eigenes Deutsch hat sie sich maßgeblich durch das Lesen erarbeitet. Nun gibt sie diese Leidenschaft weiter: Alle zwei Wochen treffen sich im virtuellen Lesekreis Lernende und Freiwillige, um über vorab vereinbarte Texte zu sprechen – die Bandbreite reicht von Harry Potter bis Franz Kafka. In kleinen Breakout-Rooms geht es dabei weniger um strenge Literaturkritik, sondern vielmehr darum, das freie Sprechen zu üben und eigene Erfahrungen zu teilen.

Das Paradoxon des Erfolgs: Wenn die Förderung wegbricht

Es sind genau diese Momente der Begegnung und Integration, die aktuell auf dem Spiel stehen. Denn während die Community wächst und floriert, tickt im Hintergrund die finanzielle Uhr. Eine substanzielle Förderung der Deutschen Fernsehlotterie in Höhe von 400.000 Euro, die dem Start-up zwei Jahre lang Luft zum Atmen und Wachsen gab, ist Ende 2025 ausgelaufen. Das Kernteam wurde zwar vergrößert, doch die laufenden Betriebskosten für Server, technischen Support und das Matchmaking bleiben …

Hier schnappt die Falle des deutschen Fördersystems zu. Stiftungen und staatliche Töpfe finanzieren gerne den innovativen Aufbau oder Pilotphasen. Ist ein Projekt jedoch etabliert und läuft erfolgreich, ziehen sich die Geldgeber*innen zurück. Sozialunternehmer wie Oliver Berlin verbringen infolgedessen oft mehr Zeit mit dem Schreiben von Anträgen als mit ihrer eigentlichen gesellschaftlichen Mission.

Kooperationen statt Rückzug

Trotz des immensen Drucks richtet das Team den Blick nach vorn und setzt auf eine strategische Neuausrichtung. Jüngst schloss Little World ein Bündnis mit Lern-Fair, einem Verein zur Unterstützung bildungsbenachteiligter Schüler*innen. Durch diese Zusammenarbeit sollen Ressourcen geteilt und neue Zielgruppen, wie etwa Eltern, erschlossen werden.

Zusätzlich rückt die Wirtschaft stärker in den Fokus. Das Social Start-up positioniert sich zunehmend als Tool für Unternehmen, die ihren Mitarbeitenden über Corporate Volunteering ein unkompliziertes Engagement ermöglichen wollen. Gleichzeitig können Firmen so frühzeitig Kontakt zu internationalen Talenten aufbauen. Um das Modell auf breitere Schultern zu stellen und die Struktur langfristig zu sichern, sollen neben Spenden künftig auch Stiftungen und Unternehmen eine entscheidende Rolle spielen. „Sprachvermittlung ist unser Vehikel – unser Ziel ist gesellschaftlicher Zusammenhalt“, appelliert Berlin.

Steckrübe statt Schwein: Verrano sichert sich hohe sechsstellige Finanzierung für die „Clean Label“-Revolution

Das 2023 gegründete Frankfurter Start-up Verrano hat ein neuartiges Verfahren entwickelt, das regionales Wurzelgemüse durch Reifung und Räucherung in eine pflanzliche Alternative zu Wurstersatzprodukten verwandelt.

Hinter Verrano, das Anfang 2023 in Frankurt/Main gegründet wurde, steht ein branchenerfahrenes, dreiköpfiges Gründerteam rund um Geschäftsführer Manuel Siskowski. Die Idee reifte jedoch schon lange vor der formellen Gründung. Getreu dem internen Motto „natürlich köstlich“ experimentierten die Gründer – zu denen auch Maximilian Bubenheim mit seiner Erfahrung aus der Sternegastronomie sowie Felix Linnenschmidt gehören – mehrere Jahre mit Wurzelgemüse.

Dabei wendeten sie ein Verfahren an, das in ähnlicher Form beim Reifen von klassischem Schinken zum Einsatz kommt. Nach ersten erfolgreichen Testläufen im regionalen Bio-Handel konnten bald die ersten Kund*innen mit Mengen aus der in Biebertal bei Gießen installierten Pilotanlage beliefert werden.

Handwerkstradition trifft Gemüse

Anstatt klassische Fleischersatzprodukte nachzuahmen, setzt Verrano auf die handwerkliche Veredelung. Regionale Rohstoffe wie Steckrübe, Sellerie und Rote Beete werden einem speziellen Fermentations- und Räucherverfahren unterzogen. Das Endprodukt zeichnet sich durch einen enormen Gemüseanteil von rund 95 Prozent aus und kommt mit nur wenigen Zutaten aus, ohne künstliche Zusatzstoffe zu verwenden. Das Ergebnis soll laut Unternehmensangaben in seiner Textur und dem Geschmack an hochwertige Fleischprodukte wie Schinken erinnern. Die kulinarischen Kreationen werden bereits als dünner Aufschnitt, im Würfelmix oder am Stück in den Markt eingeführt und eignen sich flexibel als Brotbelag, zum Kochen oder für Snackplatten. Die Innovationskraft dieses Ansatzes wurde kürzlich von PETA mit dem „VEGAN AWARD 2026“ in der Kategorie „beste vegane Innovation“ ausgezeichnet.

Eine neue Kategorie jenseits der Imitation

Der Markt für pflanzliche Alternativen konsolidiert sich aktuell, während die Lebensmittelbranche verstärkt nach innovativen pflanzlichen Produkten sucht, die neue Geschmackserlebnisse erzeugen. Hier positioniert sich Verrano in der stark wachsenden Nische der „Clean Label“-Produkte. Direkte Wettbewerber*innen mit einem identischen Ansatz sind rar, da die meisten großen Player*innen weiterhin auf Extrusionsverfahren von Proteinisolaten setzen. Verrano erschafft vielmehr eine neue Kategorie: Eine pflanzliche Feinkost, die das Naturprodukt Gemüse transformiert. Dass diese Nische massentauglich ist, bewies das Start-up jüngst im Veganuary durch aufmerksamkeitsstarke Listungen deutschlandweit in den Bordbistros der Deutschen Bahn.

Die Herausforderungen am Markt

Trotz der vielversprechenden Traction und der Skalierbarkeit, die bereits mit der Pilotanlage bewiesen wurde, steht das Start-up vor großen operativen Herausforderungen, um den Start im breiten Handel zu ermöglichen. Ein Reifeprozess, der Wochen in Anspruch nimmt, bindet extrem viel Working Capital, da enorme Mengen vorproduziert und gelagert werden müssen. Zudem verhält sich Gemüse im Reifeprozess mikrobiologisch grundlegend anders als Fleisch. Die Qualitätssicherung erfordert hochpräzise Produktionsumgebungen, um die Haltbarkeit bei größeren Mengen zu garantieren. Letztlich bedarf es auch starker Aufklärungsarbeit und forcierter Vertriebsaktivitäten am Konsument*innen, um Wurzelgemüse dauerhaft als Premium-Feinkostprodukt zu etablieren.

Reale Skalierung statt VC-Hype

Genau bei diesen Herausforderungen zeigt sich die strategische Passung der aktuellen Finanzierungsrunde. Dass Verrano die bestehenden Produktionskapazitäten massiv ausweiten muss, um die ansteigende Nachfrage zu bedienen, ist der klassische Flaschenhals von Food-Start-ups. Der überwiegende Teil der eingeworbenen Mittel fließt in genau diesen Zweck. Dass die Finanzierungsrunde dabei, wie StartingUp aus Branchenkreisen erfuhr, im hohen sechsstelligen Bereich liegt, beweist die Kapitaleffizienz des Unternehmens. Anstatt reines Risikokapital in teure Eigenentwicklungen zu pumpen, setzt Verrano auf „Smart Money“.

Mit dem Maschinenbauer Weber Food Technology und der Wurst- und Schinkenmanufaktur Bedford holen sie sich zwei strategische Industrie-Schwergewichte an Bord. Verrano profitiert hier direkt von jahrzehntelanger Expertise in der mikrobiologischen Reifung sowie im industriellen High-Tech-Slicing. Zusammen mit der BMH, die als VC-Tochter der Helaba aktuell Fonds mit einem Volumen von 450 Millionen Euro verwaltet, hat das Start-up starke Partner für die anstehende Geschäftsentwicklung gewonnen. Dieses Konsortium bietet das Rüstzeug, um die Nische der veganen Boutiquen zu verlassen und den Lebensmitteleinzelhandel zu adressieren.

deeplify sammelt 2 Mio. Euro für digitalisierte Inspektionen von Pipelines, Chemieanlagen und Brücken

Das 2023 von Jan Löwer, Christoph Siemer und Felix Asanger gegründete Bochumer Industrial-AI-Start-up deeplify bringt frischen Wind in die analog geprägte und sicherheitskritische Anlagenprüfung.

Die Überwachung von Pipelines, Chemieanlagen und Brücken unterliegt strengsten Sicherheitsvorgaben. Die sogenannte zerstörungsfreie Prüfung (ZfP / NDT) – beispielsweise mittels Ultraschall oder Röntgen – wird traditionell von zertifizierten Prüfer*innen durchgeführt. Die Dokumentation und Auswertung dieser Daten ist in der Regel zeitaufwendig und stark analog geprägt. An dieser Schnittstelle positioniert sich die 2023 gegründete deeplify GmbH aus Bochum. Das Start-up entwickelt KI-Software für sicherheitskritische Inspektionen in Energie, Chemie und Industrie. Die angebotene Software-Plattform soll Aufgabenmanagement, eine KI-gestützte Defektanalyse sowie die Berichtserstellung in einem System bündeln.

Vom Agenturgeschäft zur SaaS-Lösung

Die Idee zu deeplify entstand 2022 aus einer Data-Science-Agentur heraus. Das heutige Führungsteam setzt sich aus drei Personen mit unterschiedlichen fachlichen Schwerpunkten zusammen. CEO Jan Löwer, ein studierter Physiker und vormaliger Gründer besagter Agentur, verantwortet die strategische Ausrichtung des Unternehmens. Die operativen Prozesse steuert Christoph Siemer (COO), der zuvor über zehn Jahre als Manager beim Energiekonzern BP tätig war – eine Branchenerfahrung, die dem Start-up den vertrieblichen Zugang zur Schwerindustrie erleichtern soll. Die technische Entwicklung leitet der Robotik- und Kognitionsexperte Felix Asanger (CTO).

Auf die Frage, woran das anfängliche Agenturmodell im spezifischen Markt gescheitert sei, stellt CEO Jan Löwer klar: „Gescheitert ist das Agenturmodell nicht. Es hat funktioniert und Umsatz gebracht.“ Es sei jedoch auf einen breiteren Markt industrieller Anwendungen ausgelegt gewesen. Den Wechsel zum reinen Software-as-a-Service (SaaS)-Produkt erklärt der Gründer mit dem klaren Blick auf Marktchancen: „Wir haben dabei gesehen, dass im SaaS-Produkt das deutlich größere Skalierungspotenzial liegt.“ Der Pivot sei eine bewusste strategische Entscheidung gewesen, fügt Löwer hinzu: „Wir haben uns gefragt, wo wir den größten Hebel haben und die Antwort war eindeutig.“

Plattformansatz für Inspektionsdaten

Mit dem Produkt „deeplify inspect“ verfolgt das Unternehmen das Ziel, die oft fragmentierten Prüfdaten verschiedener Hardware-Hersteller*innen in einer DICONDE-kompatiblen Datenbank zu zentralisieren. Darauf aufbauend sollen KI-Algorithmen die Inspektor*innen bei der Fehlererkennung unterstützen. Das SaaS-Modell verspricht eine Standardisierung der Qualitätssicherung sowie eine Reduktion der Auswertungskosten. Laut Unternehmensangaben konnte deeplify bereits erste Kund*innen im Energiesektor gewinnen. Dazu zählt unter anderem der Fernleitungsnetzbetreiber Open Grid Europe (OGE), mit dem im Zuge von Transformationsprojekten Datensätze zusammengeführt wurden. Zudem gibt es Kooperationen mit Inspektionsunternehmen.

Die Schwerindustrie gilt als konservativ, und Hardware-Hersteller setzen oft auf eigene Software-Silos. Löwer sieht darin jedoch keine unüberwindbare Hürde: „Vendor-Lock-ins sind in der Anlagenprüfung weniger ausgeprägt. Betreiber setzen mehrere Hardware-Lösungen parallel ein und legen Wert auf Unabhängigkeit.“ Deeplify positioniere sich exakt an diesem Punkt: „Als herstellerunabhängige Plattform integrieren wir Inspektionsdaten aus bestehenden Systemen über standardisierte Schnittstellen und überführen sie in ein offenes Format“, betont der Gründer.

Das Versprechen an die Industrie formuliert er deutlich: „Die Unternehmen behalten ihre Hardware, wir schaffen auf der Datenebene zentrale Verfügbarkeit, Vergleichbarkeit und KI-gestützte Auswertung.“ Um die Lösung auch für Konzerne wie OGE wirtschaftlich attraktiv zu machen, verzichtet deeplify beim Pricing bewusst auf große Upfront-Investments. Löwer skizziert das Modell: „Unternehmen starten mit einer Testphase und geringen Einstiegshürden, der Funktionsumfang skaliert modular mit dem tatsächlichen Bedarf.“

Marktumfeld & regulatorische Barrieren

Der Markt für Asset-Integrity-Management wächst, bedingt durch eine alternde europäische Infrastruktur und einen zunehmenden Mangel an qualifiziertem Prüfpersonal. Gleichzeitig sind die Markteintrittsbarrieren extrem hoch. In sicherheitskritischen Bereichen gelten strenge Zertifizierungsvorgaben, und die Haftungsrisiken bei übersehenen Defekten sind immens.

Um die regulatorischen Hürden zu umgehen, positioniert deeplify seine KI nicht als autonomen Prüfer, sondern wählt einen „Human-in-the-loop“-Ansatz. Die Software assistiert, die finale rechtliche Verantwortung und Entscheidungsgewalt verbleibt bei den menschlichen Prüferinnen. Auf das Risiko angesprochen, dass Prüferinnen sich zunehmend blind auf die KI verlassen könnten (Automation Bias), kontert Löwer: „Unser Ziel ist nicht, den Prüfer zu ersetzen, sondern seine Entscheidungsqualität messbar zu stärken.“ Er bezeichnet den Human-in-the-loop-Ansatz als „bewusstes Designprinzip“. Die KI sei primär als Assistenzsystem konzipiert: „Sie macht Vorschläge transparent, weist Unsicherheiten aus und liefert nachvollziehbare Entscheidungsgrundlagen“, so der CEO. Er versichert zudem, dass bestehende Prüfprozesse, Normen und Vier-Augen-Prinzipien vollständig erhalten blieben.

Auch das Training der KI-Modelle erfordert den Zugang zu hochspezifischen, oft vertraulichen Datensätzen der Anlagenbetreiber*innen. Löwer erklärt die Beschaffung dieser sensiblen Daten: „Beim Thema Trainingsdaten setzen wir auf enge Partnerschaften mit Anlagenbetreibern, die uns bereits für Entwicklung und Validierung reale Prüfdaten zur Verfügung stellen.“ Das ermögliche praxisnahes Training und stelle sicher, „dass unsere Modelle unter realen Bedingungen zuverlässig arbeiten“.

Der technologische Burggraben im starken Wettbewerb

Der NDT-Softwaremarkt ist stark fragmentiert und zunehmend umkämpft. Auf der einen Seite stehen internationale Start-ups und Scale-ups wie HUVRdata oder Abyss Solutions sowie Tech-Spezialisten wie Screening Eagle. Auf der anderen Seite rüsten etablierte NDT-Riesen wie Waygate Technologies ihre Systeme mit KI-Komponenten aus, während Prüfkonzerne wie TÜV oder SGS signifikant in Digitalisierungseinheiten investieren.

Deeplify muss beweisen, dass der herstellerunabhängige SaaS-Ansatz diesen teils proprietären Systemen überlegen ist. Globale Konzerne und Hardware-Marktführer sitzen auf riesigen historischen Datenbergen. Auf die Frage nach dem tatsächlichen technologischen Burggraben (Moat) gegenüber etablierten Playern stellt Löwer einen grundlegenden Besitzanspruch klar: „Der entscheidende Punkt ist: Die Daten gehören den Anlagenbetreibern, nicht den Hardware-Herstellern“. Deeplify positioniere sich als herstellerunabhängige Daten- und KI-Schicht, „die systemübergreifend integriert und erstmals echte Interoperabilität in der Anlagenprüfung schafft“.

Den eigenen Wettbewerbsvorteil definiert Löwer sehr spezifisch: „Unser Moat liegt in der Kombination aus tiefem NDT- und Asset-Integrity-Know-how mit spezialisierten, proprietären KI-Modellen, die direkt auf Rohdatenebene arbeiten.“ Der Gründer übt in diesem Zusammenhang auch Kritik am Status quo der Branche: „Viele etablierte Anbieter sind in ihren eigenen Ökosystemen gefangen und können diese Perspektive kaum abbilden.“ Durch Projekte und Partnerschaften baue deeplify kontinuierlich einen praxisnahen Datenkontext auf, „der nicht als Silo funktioniert, sondern als lernende, interoperable Plattform wächst“, schließt Löwer.

Finanzierung & Ausblick

Zur Finanzierung des weiteren Wachstums schließt deeplify nun offiziell eine Pre-Seed-Runde über 2 Mio. Euro ab. Lead-Investor ist D11Z Ventures. Außerdem beteiligen sich Vanagon Ventures, EWOR und strategische Business Angels. Mit dem frischen Kapital will deeplify die technische Infrastruktur der Plattform ausbauen und weitere Einführungen bei Kund*innen in Europa beschleunigen.

Trotz der Wurzeln im Ruhrgebiet sucht das Start-up für die Entwicklung von sogenannter Agentic AI laut öffentlichen Hiring-Daten nun Personal am Standort München. Löwer begründet diese Entscheidung mit den ambitionierten Zielen des Unternehmens: „Deeplify ist auf einem Wachstumskurs. Wir benötigen die besten Talente für unser Team.“ Die Wahl des neuen Standorts sei folgerichtig: „München ist eine bewusste strategische Entscheidung. Die Stadt bietet Zugang zu einem der stärksten KI-Talentpools in Europa, ein dichtes Ökosystem aus DeepTech-Unternehmen und Forschungseinrichtungen sowie die Nähe zu potenziellen Industriekunden."

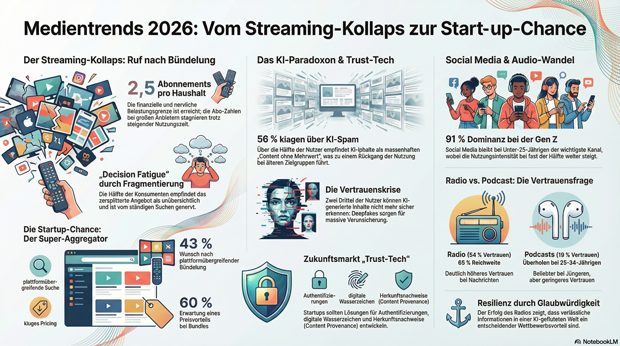

Mediennutzung 2026: Zwischen KI-Frust, Abo-Müdigkeit und neuen Chancen für Start-ups

Die Deutschen experimentieren so intensiv wie nie mit künstlicher Intelligenz (KI), sind aber zunehmend genervt von Deepfakes und „Content ohne Mehrwert“. Gleichzeitig sehnt sich der überhitzte Streaming-Markt nach einer drastischen Konsolidierung. Die aktuelle Deloitte-Studie „Media Consumer Trends 2026“ liefert nicht nur Bestandsaufnahmen, sondern zeigt deutlich, wo für Gründer*innen und Tech-Unternehmen jetzt die wahren Opportunitäten liegen.

Social Media bleibt der unangefochtene Platzhirsch der Medienlandschaft: 78 Prozent der Konsument*innen in Deutschland sind auf den Plattformen aktiv, bei der Gen Z (unter 25 Jahre) sind es sogar satte 91 Prozent. Fast die Hälfte dieser jungen Zielgruppe nutzt Instagram, TikTok und Co. heute intensiver als noch im Vorjahr. Doch ein Blick unter die Oberfläche offenbart Risse im digitalen Fundament – und die haben maßgeblich mit dem rasanten Einzug generativer künstlicher Intelligenz (KI) zu tun.

Das KI-Paradoxon: Große Kreationslust, massives Vertrauensproblem

Auf der Creator-Seite ist KI bereits Alltag. 22 Prozent der Befragten haben laut Deloitte schon Bilder per KI erstellt, jeder Zehnte generiert Videos oder Musik. Auch die Zahlungsbereitschaft ist überraschend hoch: Jeder Fünfte wäre bereit, monatlich über 10 Euro für entsprechende Tools auszugeben.

Auf der Konsument*innenseite jedoch kippt die Stimmung bedenklich. Zwei Drittel der Nutzer*innen geben an, dass sie KI-generierte Inhalte im Netz nicht mehr zuverlässig erkennen können. Schlimmer noch: 56 Prozent klagen über eine wachsende Flut an KI-generierten Postings „ohne Mehrwert“ – schlichtweg digitaler Spam. Die Konsequenz dieser Verunsicherung zeigt sich bereits in den Nutzungsdaten: Erste Altersgruppen, insbesondere Nutzer*innen ab Mitte 50, beginnen, ihren Social-Media-Konsum aktiv zurückzufahren.

Die Start-up-Perspektive: Die Zeiten des blinden KI-Hypes sind vorbei. Wer als Gründer*in heute rein quantitativ auf automatisierte Content-Erstellung setzt, riskiert Reichweite und Glaubwürdigkeit. Wie Deloitte-Expertin Sophie Pastowski anmerkt, braucht es dringend „transparente Kennzeichnung, um Vertrauen im digitalen Raum zu stärken.“ Genau hier entsteht ein massiver Zukunftsmarkt für „Trust-Tech“-Start-ups: Werkzeuge, die Authentizität verifizieren, Deepfakes zuverlässig herausfiltern, digitale Wasserzeichen etablieren oder Content-Provenance (Herkunftsnachweise) sichern, werden zu kritischen Erfolgsfaktoren für Plattformen und Verlage.

Streaming-Kollaps: Die Sehnsucht nach dem Super-Aggregator

Auch im Video-Streaming-Markt (SVoD) stehen die Zeichen auf Wandel. Der Markt ist in einer Reifephase angekommen: Zwar verbringen die Deutschen immer mehr Zeit mit Streaming, doch die Abo-Zahlen stagnieren. Mit durchschnittlich 2,5 Abos bei 64 Prozent der Haushalte ist die finanzielle und nervliche Schmerzgrenze offenbar erreicht.

Die Fragmentierung des Marktes wird zum Bumerang. Die Hälfte der Konsument*innen findet das zersplitterte Angebot unübersichtlich; das ständige Suchen nach Inhalten über verschiedene Apps hinweg („Decision Fatigue“) nervt. Das Resultat ist ein lauter Ruf nach Bündelung: 43 Prozent der Nutzer*innen wünschen sich eine plattformübergreifende Aggregation ihrer Dienste. Der Haken für Anbietende: 60 Prozent erwarten im Gegenzug für ein solches Bundle einen spürbaren Preisvorteil.

Die Start-up-Perspektive: Der Markt schreit nach einer funktionierenden Meta-Ebene. Wer es schafft, die zersplitterte Content-Landschaft in einer nutzer*innenfreundlichen Oberfläche (Super-App) mit intelligenter, plattformübergreifender Suchfunktion und klugem Pricing zu bündeln, trifft den absoluten Nerv der Zeit. Das reine Hinzufügen eines weiteren Nischen-Streamingdienstes dürfte es hingegen 2026 schwerer denn je haben.

Audio: Der harte Kampf um das knappe Gut „Glaubwürdigkeit“

Im Audio-Segment setzt sich der Strukturwandel fort. Podcasts boomen weiter und haben bei den 25- bis 34-Jährigen das klassische Radio bereits als wichtigstes Medium überholt. Doch das Radio verzeichnet mit 65 Prozent wöchentlicher Reichweite weiterhin eine enorme Resilienz. Der Grund ist ein entscheidender USP, von dem digitale Kanäle lernen können: Vertrauen. Wenn es um harte Informationen und die Nachrichtenlage geht, stufen 54 Prozent der Hörer das Radio als informativer und verlässlicher ein – Podcasts kommen hier nur auf 19 Prozent.

Fazit

Die Mediennutzung 2026 ist stark paradox geprägt: Technologie durchdringt die Erstellung von Inhalten immer tiefer, doch die Sehnsucht der Nutzer*innen nach Authentizität, Übersichtlichkeit und verlässlichen Quellen wächst proportional dazu. Für Start-ups bedeutet dies einen strategischen Paradigmenwechsel. Nicht das nächste Tool zur Erstellung von noch mehr billigem KI-Content ist der heilige Gral, sondern Lösungen, die in der Informationsflut Orientierung schaffen, Fragmentierung auflösen und echtes Vertrauen im digitalen Raum aufbauen. Wer diese Schmerzpunkte adressiert, hat im hart umkämpften Medienmarkt der kommenden Jahre exzellente Karten.

Architektur statt Strukturgröße: Aachener Chip-Start-up INCIRT sichert sich 4,8 Mio. Euro