Aktuelle Events

Deutscher Innovationsgipfel 2024

Der vom Innovation Network veranstaltete DEUTSCHE INNOVATIONSGIPFEL (DIG) findet am 15. Mai 2024 in München statt und ist das branchen- & technologieübergreifende Entscheider*innentreffen, das Innovator*innen und Führungskräfte aus Wirtschaft, Wissenschaft, Politik und anderen Bereichen zusammenbringt, um Ideen auszutauschen, Best Practices zu teilen und innovative Lösungen für aktuelle Herausforderungen zu diskutieren.

Neben großen, innovativen Unternehmen und Partnern des DIG wie AUDI, DB Systel, Drees & Sommer, Miele, IMP und Volocopter sowie kreativen Köpfen von Start-ups wie Rooom, Hasytec und Marvel Fusion bietet der Deutsche Innovationsgipfel 2024 auch Start-ups wieder die Chance, neue Kund*innen, hochwertige Kontakte und große Deals auf dem crossindustriellen Entscheider*innentreffen am 15. Mai in München einzufädeln.

StartUP – WarmUP: Start-ups for Breakfast

Gleich zum Auftakt des 17. Deutschen Innovationsgipfels präsentieren sich die Gründer*innen dann im StartUP – WarmUP. Moderiert werden die Pitch-Präsentationen in lockerer Frühstücksrunde von Moritz Förster, Managing Partner bei den TechFounders, Deutschlands erfolgreicher Start-up-Rampe. So neugierig auf sich und ihr Unternehmen gemacht, haben die Start-ups direkt im Anschluss dann die Möglichkeit, sich an einem eigenen Stand auf dem Showfloor zu präsentieren und ganztägig für individuelle Gespräche zur Verfügung zu stehen.

Damit die Teilnehmer*innen des 17. Deutschen Innovationsgipfels – jede(r) zweite Besucher*in gehört der Geschäftsführung bzw. dem Vorstand eines Unternehmens an – auch möglichst schnell in intensive Gespräche kommen, hinterliegt dem „innovativsten Tag des Jahres“ ein einmaliges Konzept in sich verzahnter Bausteine.

Business-Speed-Dating, hochkarätige Talks, profunde Keynotes oder interaktive Workshops

Ob Business-Speed-Dating, hochkarätige Talks, profunde Keynotes oder interaktive Workshops: den Teilnehmenden stehen vielfältige Möglichkeiten zur Verfügung, um sich über die wichtigsten Aspekte von Innovation zu informieren.

Ein thematischer Schwerpunkt liegt naturgemäß auf dem wichtigen (Zukunfts-)Thema künstliche Intelligenz. Unter anderem werden folgende Aspekte behandelt: Wie wird KI unsere Arbeitsweise maßgeblich verändern? Warum KI nicht nur eine technologische, sondern ganzheitliche Herausforderung ist.

Darüber hinaus widmen sich die Programmpunkte u.a. den Themen OpenInnovation, Kundenzentrierte Innovationsprozesse, Start-ups und Mittelstand – eine echte Chance für Deutschland, Technology Push und Market Pull als Tools zur Aufwärtsspirale sowie Digitale Transformation war gestern – radikales Neudenken für eine erfolgreiche Zukunft.

Am Ende des hochkarätigen Events wartet auf die Teilnehmenden ein musikalischer Ausklang unter dem Motto: „Innovation trifft Kultur“.

Die vollständige Agenda des 17. Deutschen Innovationsgipfels gibt’s hier

Auf einen Blick:

Was: 17. Deutscher Innovationsgipfel

Wann: 15. Mai 2024

Wo: The Charles Hotel, Sophienstraße 28, 80333 München

Info und Tickets: http://www.deutscher-innovationsgipfel.de/

Diese Artikel könnten Sie auch interessieren:

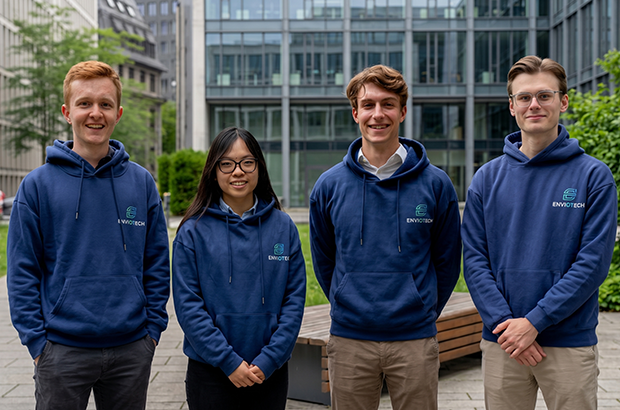

ENVIOTECH sichert sich Millionenfinanzierung für intelligente öffentliche Straßenbeleuchtung

Das Frankfurter Start-up ENVIOTECH rund um Adrian Rhaese, Linh Pham, Dustin Arnold und Peter Kletsko hat eine Pre-Seed-Runde in Höhe von einer Million Euro abgeschlossen, um öffentliche Straßenbeleuchtung intelligent nachzurüsten. Doch der Markt für kommunale Infrastruktur ist hart umkämpft und bürokratisch. Kann das junge Team die öffentlichen Verwaltungen überzeugen?

Es ist ein klassisches Gründer*innen-Narrativ: Aus einem persönlichen Schmerzpunkt entsteht eine Geschäftsidee. Im Fall von ENVIOTECH war es ein Fahrradunfall. Der beste Freund von Mitgründer Adrian Rhaese verunglückte, weil in einer deutschen Stadt die Straßenlaternen aufgrund gestiegener Stromkosten abgeschaltet worden waren. Dieser Vorfall weckte bei Rhaese das Unverständnis darüber, dass in einem wirtschaftlich starken Land ausgerechnet an der Sicherheit gespart wird – und legte den Grundstein für das Smart-City-Start-up.

Bye-bye Bankenturm: Der Sprung ins kalte Wasser

Anstatt ihren als sicher geltenden Karriereweg fortzusetzen, verließen Adrian Rhaese und Mitgründerin Linh Pham ihre Positionen als duale Studierende bei der Deutschen Bank. Sie entschieden sich bewusst für das unternehmerische Risiko, um reale Infrastrukturprobleme zu lösen.

Eine erste Bestätigung für diesen Schritt erhielt das junge Team durch die Aufnahme in das EWOR Fellowship. Daniel Dippold, Gründer und CEO von EWOR, bescheinigt dem Team den richtigen Fokus: „Unspektakuläre Infrastruktur gewinnt langfristig fast immer. Straßenbeleuchtung ist nicht glamourös, aber sie ist allgegenwärtig, unverzichtbar und aus keiner Stadt wegzudenken.“

Plug-and-Play am Lichtmast: Das 15-Minuten-Update

Die technische Lösung von ENVIOTECH setzt auf Pragmatismus: Anstatt Laternen kostenintensiv komplett auszutauschen, bietet das Unternehmen ein Retrofit-System an. Das Produkt soll sich laut Unternehmensangaben in unter 15 Minuten in bestehende Leuchten integrieren lassen.

Die nachgerüsteten Laternen kommunizieren als Mesh-Netzwerk miteinander und dimmen das Licht KI-gesteuert und bedarfsgerecht anhand von Bewegungserkennung. Das Startup verspricht dadurch Energieeinsparungen von bis zu 80 Prozent; gleichzeitig soll die öffentliche Sicherheit erhöht werden. Kommunen erhalten so die Möglichkeit, ihre Beleuchtung zentral zu steuern und in Echtzeit zu überwachen.

Um das Konzept in die Fläche zu tragen, konnte ENVIOTECH nun eine Pre-Seed-Finanzierung in Höhe von 1 Million Euro einsammeln. Angeführt wird die Runde passenderweise vom ehemaligen Co-CEO der Deutschen Bank, Jürgen Fitschen. Ergänzt wird das Konsortium durch Ex-MAN-CEO Joachim Drees, Alexander Eyhorn (Gründer von Bidirex) und Danilo Jovicic-Albrecht (Mitgründer des auf Kommunen spezialisierten Startups Vialytics). Mit dem frischen Kapital sollen Pilotprojekte forciert und das Technologieportfolio weiterentwickelt werden.

Der Endgegner heißt B2G-Markt: David gegen die Industrie-Goliaths

So einleuchtend die Technologie klingt, das Geschäftsmodell von ENVIOTECH steht vor gewaltigen Hürden. Der B2G-Markt (Business-to-Government) ist für Start-ups extrem schwierig. Kommunen, die ENVIOTECHs primäre Zielgruppe darstellen, arbeiten mit langen Budgetzyklen und streng regulierten öffentlichen Ausschreibungsverfahren. Bis ein Pilotprojekt zu einem flächendeckenden Rollout führt, vergehen oft Jahre.

Darüber hinaus agiert das Start-up nicht im luftleeren Raum. Der Smart-Lighting-Markt wird von Industriegiganten wie Signify oder Schréder dominiert, die längst eigene IoT-Lichtsteuerungssysteme anbieten. Auch andere Start-ups wie Tvilight oder Icegateway haben das Potenzial vernetzter Straßenbeleuchtung erkannt.

Der entscheidende USP von ENVIOTECH muss daher in der Geschwindigkeit und Einfachheit liegen: Gelingt die versprochene rasante Installation und können Kommunen die Lösung ohne massive Tiefbauarbeiten testen, hat das Start-up einen echten Wettbewerbsvorteil. Besonders klug ist hierbei die Auswahl der Investor*innen: Mit Drees und Jovicic-Albrecht hat das Gründerduo Köpfe an Bord geholt, die wissen, wie man komplexe Produkte an die öffentliche Hand verkauft. Schafft es ENVIOTECH, den extrem zähen Vertriebszyklus öffentlicher Verwaltungen zu knacken, könnte das Unternehmen zu einem hochrentablen Hidden Champion heranwachsen.

Wie das TechBio-Start-up mbiomics mit 30 Mio. Euro die Krebstherapie skalierbar machen will

Stuhltransplantationen haben gezeigt, dass das Darmmikrobiom ein mächtiger Hebel gegen Krebs sein kann – doch der Ansatz ist bisher kaum standardisierbar. Das Münchner Unternehmen mbiomics setzt auf künstliche Intelligenz und maßgeschneiderte Bakterien-Cocktails aus dem Labor. Mit dem Abschluss einer 30-Millionen-Euro-Serie-A-Runde rückt die klinische Phase näher. Ein genauer Blick auf das Geschäftsmodell, die Gründer*innen und einen hart umkämpften globalen Markt.

Wer heute von modernster Krebstherapie spricht, kommt am menschlichen Darm nicht mehr vorbei. Die wissenschaftliche Datenlage der letzten Jahre hat sich massiv verdichtet: Ob ein Patient auf revolutionäre Krebs-Immuntherapien (wie Immun-Checkpoint-Inhibitoren) anspricht, hängt maßgeblich von der individuellen Zusammensetzung seines Mikrobioms ab. Das Münchner TechBio-Unternehmen mbiomics hat sich genau dieses Zusammenspiel zur Mission gemacht und gab heute den dritten Abschluss seiner Serie-A-Finanzierungsrunde bekannt. Mit neu eingeworbenen 12 Millionen Euro wächst das Gesamtvolumen der Runde auf beachtliche 30 Millionen Euro.

Das Kapital, das unter anderem von erfahrenen Investoren wie den MIG Fonds und Bayern Kapital stammt, markiert für das 2020 gegründete Unternehmen einen entscheidenden Wendepunkt: den Übergang von der reinen Technologieplattform hin zur klinischen Anwendung am Menschen. Der führende Wirkstoffkandidat „MBX-116“ soll 2027 in einer Phase-1B-Studie an Patienten mit fortgeschrittenem schwarzen Hautkrebs (Melanom) getestet werden. Doch wie belastbar ist dieser Ansatz im Vergleich zum Wettbewerb?

Die Köpfe hinter der Vision

Aus der Taufe gehoben wurde mbiomics im Jahr 2020 von Dr. Laura Figulla, Dr. Johannes B. Wöhrstein und Dr. Markus Rinecker. Während die Mitgründer Figulla und Rinecker das Unternehmen in der frühen Phase prägten, wird die nun anstehende Skalierung und klinische Validierung von einem spezialisierten Leadership-Trio gesteuert:

- Dr. Johannes B. Wöhrstein (CEO & Mitgründer): Als technologischer Kopf und Geschäftsführer verantwortet er die firmeneigene Plattform. Seine Expertise in hochauflösender Analytik ist das Fundament, um komplexe mikrobielle Netzwerke mithilfe von maschinellem Lernen (KI/ML) überhaupt erst zu kartieren.

-

Kristin Torre Vinuesa (CFO): Als Chief Financial Officer verantwortet sie die finanziellen Geschicke des Unternehmens. Ihre Rolle ist entscheidend, um die neu eingeworbenen 30 Millionen Euro strategisch einzusetzen, den naturgemäß hohen Kapitalbedarf der anstehenden klinischen Studien („Cash Burn“) effizient zu steuern und das finanzielle Fundament für zukünftige Runden zu sichern.

- Dr. Christopher Weidenmaier (CSO): Der erfahrene Mikrobiologe (zuvor unter anderem beim US-Konkurrenten Finch Therapeutics) komplettiert das heutige Führungstrio. Als Chief Scientific Officer leitet er die präklinische Forschung und treibt das rationale Design der komplexen Bakterien-Konsortien maßgeblich voran.

Das Problem: Die Unberechenbarkeit der Natur

Um das Geschäftsmodell zu verstehen, muss man den Status quo betrachten. In der Onkologie wird aktuell intensiv mit Stuhltransplantationen (Fecal Microbiota Transplants, FMT) experimentiert. Dabei wird das Mikrobiom von Patient*innen, die hervorragend auf Krebsmedikamente ansprechen, auf „Non-Responder“ übertragen. Die Erfolge sind bemerkenswert, doch das Verfahren hat einen massiven Haken: Stuhl ist ein hochvariables Naturprodukt. Er ist schwer zu standardisieren, birgt Infektionsrisiken und lässt sich nicht als skalierbares Pharma-Produkt im industriellen Maßstab herstellen.

Hier setzt mbiomics mit sogenannten Live Biotherapeutic Products (LBPs) an. Statt auf ungefilterte Spender*innen-Transplantate zu setzen, identifiziert das Team mittels KI genau jene Bakterienstämme, die für den therapeutischen Effekt verantwortlich sind. Diese werden dann im Labor nach pharmazeutischen GMP-Standards gezüchtet und als orale Kapsel verabreicht. Es ist der Versuch, die „Blackbox“ Darm in ein berechenbares, patentierbares Medikament zu verwandeln.

Wo liegen die Risiken?

Für Beobachter*innen der Start-up-Szene bleibt das Vorhaben trotz der Millionen-Finanzierung eine Hochrisiko-Wette. Ein TechBio-Start-up in diesem Stadium hat einen enormen „Cash Burn“. Die 30 Millionen Euro sind ein starkes Fundament, doch die klinische Entwicklung in der Onkologie ist ein Langstreckenlauf, der oft dreistellige Millionenbeträge verschlingt.

Zudem ist das Geschäftsmodell hochgradig binär: Die für 2027 geplante Studie muss erst beweisen, dass die im Labor designten Bakterien-Konsortien im komplexen menschlichen Ökosystem tatsächlich die erhoffte Wirkung zeigen. Ein Scheitern des Leitkandidaten MBX-116 könnte das gesamte Vertrauen in die Plattform erschüttern. Zudem ist die Herstellung lebender Bakterien in absolut reproduzierbarer Qualität eine enorme logistische und biotechnologische Herausforderung, an der bereits andere Pioniere der Branche hängen geblieben sind.

Der Markt: Ein globales Rennen

Mbiomics ist nicht allein auf diesem Feld. Das Unternehmen muss sich gegen hochkapitalisierte internationale Konkurrent*innen behaupten:

- MaaT Pharma (Frankreich): Die Franzosen sind klinisch bereits weiter fortgeschritten und setzen auf „Full-Ecosystem“-Produkte aus gepoolten Spenderproben. Mbiomics muss beweisen, dass ihr synthetischer Präzisions-Ansatz dem natürlichen Mix überlegen ist.

- Vedanta Biosciences (USA): Ein US-Schwergewicht, das ebenfalls definierte Bakterienkonsortien entwickelt und bereits über ein breites Netzwerk an Kooperationen mit der Big-Pharma-Industrie verfügt.

Unsere Einordnung

Für das deutsche Ökosystem ist der Erfolg von mbiomics ein Leuchtturm-Signal. Dass Investoren wie MIG – die bereits bei BioNTech ein frühes Gespür bewiesen – hier massiv nachlegen, unterstreicht die Qualität des Standorts München.

Mbiomics wählt den schwierigen, aber potenziell nachhaltigeren Weg. Statt auf die bloße Kopie der Natur zu setzen, versucht das Team, das Mikrobiom durch Daten beherrschbar zu machen. Gelingt der klinische Wirksamkeitsnachweis ab 2027, könnte das Start-up nicht nur die Onkologie verändern, sondern auch Blaupausen für die Behandlung von Autoimmun- und neurodegenerativen Erkrankungen liefern. Der Weg bis dahin bleibt jedoch teuer und wissenschaftlich riskant.

Cyber-Souveränität als Geschäftsmodell: QuoIntelligence sichert sich 7,3 Mio. Euro für den europäischen Markt

Regulierung als Wachstumstreiber: Das Frankfurter Cyber-Security-Start-up QuoIntelligence sammelt in seiner Series-A-Finanzierungsrunde 7,3 Millionen Euro ein. Das Versprechen: Hochwertige, fertig analysierte Cyber-Bedrohungsdaten speziell für den europäischen Mittelstand. Doch wie skalierbar ist der Spagat zwischen KI-Automatisierung und menschlicher Analyse, wenn man gegen etablierte US-Giganten antritt?

Der Weg von QuoIntelligence ist eng mit der Biografie seines Gründers Marco Riccardi verknüpft. Riccardi verbrachte sieben Jahre tief im IT-Sicherheitsapparat des Frankfurter Finanzsektors: Von 2013 bis 2015 war er als IT-Security-Berater für die Europäische Zentralbank (EZB) tätig, gefolgt von zwei Jahren als Threat Intelligence Analyst bei der Deutschen Bank. Vor der Gründung von QuoIntelligence Anfang 2020 leitete er zudem die Intelligence Operations beim Frankfurter Unternehmen QuoScient.

Heute führt Riccardi das Start-up mit einem europäisch aufgestellten Management-Team, dem unter anderem David Brown (UK), Antonio Arias Lopez (Deutschland), Odín Rodríguez Lago (Spanien) und Marina Gómez Lara (Spanien) angehören.

„Finished Intelligence“ statt roher Daten-Feeds

QuoIntelligence positioniert sich als Anbieter für „Unified Risk Intelligence“. Das Kernproblem vieler Unternehmen: Der Aufbau eines eigenen Cyber-Intelligence-Teams erfordert oft sechsstellige Investitionen allein für Fachpersonal. QuoIntelligence verspricht hier Abhilfe durch „Finished Threat Intelligence“ – fertig analysierte und kontextualisierte Bedrohungsinformationen, die innerhalb weniger Stunden einsatzbereit sind, ohne dass der Kunde ein eigenes internes Expertenteam benötigt.

Technologisch stützt sich das Unternehmen dabei auf zwei Säulen:

- Mercury: Die hauseigene Plattform aggregiert Erkenntnisse aus über 1.000 Quellen und nutzt eine kuratierte Wissensbasis von über 17.000 geprüften Intelligence-Tickets.

- KARLA: Ein konversationeller KI-Analyst soll diese komplexen Informationen für alle Unternehmensebenen – vom Vorstand bis zum Sicherheitsanalysten – zugänglich machen.

Das Modell stößt auf eine beachtliche Marktresonanz: Für das Jahr 2025 meldet das Startup keinen einzigen Kundenabgang (Zero Client Churn). Zudem hat sich der Customer Lifetime Value seit 2023 beinahe versechsfacht. Ein weiterer Vertrauensbeweis ist die Rolle als offizieller ENISA-Anbieter mit einem Vierjahresvertrag über 1,4 Millionen Euro seit Februar 2025.

Der Wachstumsmotor: NIS2, DORA und Daten-Souveränität

Die aktuelle Finanzierungsrunde wird von Elevator Ventures (Raiffeisen Bank International) angeführt und von der BMH Beteiligungs-Managementgesellschaft Hessen co-geführt. Beteiligt sind zudem eCAPITAL und Mercurius Private Equity. Dass hier vor allem Kapital mit starken Wurzeln im Finanzsektor fließt, ist strategisch logisch.

Der entscheidende Markttreiber sind die EU-Richtlinien NIS2 und DORA. Allein NIS2 erfasst europaweit über 160.000 Organisationen – davon über 30.000 in Deutschland – und führt zur persönlichen Haftung der Geschäftsführung bei Versäumnissen. Gleichzeitig fordern europäische Beschaffungsrahmen zunehmend, dass sensible Daten innerhalb der EU verbleiben. Hier zieht QuoIntelligence seinen entscheidenden Burggraben:

- Das Unternehmen ist nach deutschem Recht gegründet.

- Sämtliche Intelligence-Daten werden auf deutschem Boden unter EU-Recht gespeichert.

Die Herausforderungen

Trotz der strategisch klugen Positionierung gibt es Hürden:

- Skalierbarkeit: Das Modell setzt auf einen „Analyst-first“-Ansatz, bei dem Experten jede Information prüfen. Bei massivem Wachstum durch neue Vertriebskanäle muss die KI KARLA beweisen, dass sie diese Expert*innen effizient entlasten kann.

- Globale Konkurrenz: US-Schwergewichte wie CrowdStrike oder Mandiant verfügen über weit größere globale Daten-Netzwerke. QuoIntelligence setzt hier voll auf den Trumpf der „europäischen Souveränität“, um sich abzugrenzen.

- Mittelstands-Trägheit: Ob der Mittelstand über die reine Compliance-Erfüllung hinaus tatsächlich in tiefgehende Risiko-Intelligence investiert, wird das langfristige Wachstumstempo bestimmen.

Unser Fazit

QuoIntelligence zeigt sehr anschaulich, wie man Regulierung (NIS2/DORA) als stärksten Vertriebskanal nutzt. Die Wahl der Investor*innen aus dem Finanzsektor sichert den Zugang zur Kernzielgruppe. Mit der klaren Kante beim Datenschutz („Made in Germany“) besetzt das Start-up eine Nische, die für regulierte Unternehmen in Europa zur Pflicht wird. Gelingt der Spagat zwischen menschlicher Expertise und technischer Skalierung, könnte Frankfurt hier einen dauerhaften Champion der europäischen Cybersicherheit hervorbringen.

Vom Assekuradeur zum Cyber-Abwehrzentrum: Baobabs riskante Wette auf die All-in-One-Lösung

Es ist ein mutiger Schritt für ein junges Unternehmen: Das 2021 in Berlin gegründete InsurTech Baobab Insurance streift sein reines Versicherungs-Image ab und firmiert ab sofort unter dem Namen Baobab Risk Solutions (BRS). Zeitgleich führt das Start-up einen eigenen Managed Detection and Response (MDR) Service ein. Damit will das Unternehmen künftig nicht mehr nur den finanziellen Schaden bei Cyberangriffen abfedern, sondern die Angriffe selbst aktiv abwehren. Ein ambitionierter Plan, der das Geschäftsmodell unter enormen Leistungsdruck setzt.

„Unser neuer Name ist ein Versprechen an den Markt: Wir bieten keine bloßen Policen, sondern eine ganzheitliche Strategie gegen digitale Risiken“, erklärt Mitgründer und Geschäftsführer Vincenz Klemm. Prävention, Abwehr und Versicherung sollen fortan eine untrennbare Einheit bilden. Auf die Vermutung, das reine Versicherungsgeschäft sei für den Mittelstand schlichtweg zu unprofitabel geworden, kontert der Gründer deutlich: „Der Wechsel zu Risk Solutions ist weit mehr als ein neues Branding. Damit lösen wir unser Gründungsversprechen konsequent ein.“ Die bloße Police sei nie das Endprodukt gewesen, der Schritt zum aktiven Abwehrdienstleister sei von Tag eins an auf der Roadmap gestanden. Klemm fasst die neue Ausrichtung in einem klaren Kernsatz zusammen: „Wir warten somit nicht darauf, dass ein Schaden reguliert werden muss. Wir sorgen stattdessen aktiv dafür, dass er gar nicht erst entsteht.“ Dies sei kein Ausstieg aus der Versicherung, sondern die Evolution zum echten Risikomanagement für den Mittelstand und Industrieunternehmen.

Vom Millionen-Exit zum Cyber-Schutzschild

Um die Ambitionen von Baobab Risk Solutions zu verstehen, lohnt ein Blick auf das Gründer-Duo. Vincenz Klemm (Geschäftsführer) und Anton Foth (CTO) bringen geballte Erfahrung mit. Klemm baute in den USA den digitalen Makler Gabi auf und verkaufte ihn für rund 320 Millionen US-Dollar an Experian, während Foth als ehemaliger CTO von Coya (später Luko) die tiefe technische Expertise für datengetriebene Versicherungsmodelle liefert. Gestartet mit rund 4,2 Millionen US-Dollar Pre-Seed-Kapital, ist das Unternehmen mittlerweile in Deutschland, Österreich und den Benelux-Ländern aktiv.

Der Aufbau eines europäischen Assekuradeurs in den vergangenen fünf Jahren verlief dabei nicht ohne Hürden. „Eine europäische Expansion ist niemals eine reine Blaupause“, räumt Klemm ein. Um regulatorische Fallstricke frühzeitig zu erkennen, setze man gezielt auf lokale Expertise wie den General Manager für die Benelux-Staaten, Tim van Lier. Als größten Trumpf sieht Klemm jedoch die eigene Reaktionsgeschwindigkeit: „Wenn etwas nicht funktioniert, korrigieren wir es binnen Tagen, statt in monatelangen Release-Zyklen zu verharren.“ Auch die Frage nach frischem Kapital für den nun extrem kostenintensiven MDR-Betrieb wischt er routiniert beiseite: Man sei durch die letzte Finanzierungsrunde hervorragend aufgestellt. Sollte man dennoch nachlegen müssen, wisse man Investoren an der Seite, die „bei positiven Trends extrem schnell Kapital mobilisieren können.“

Der neue Vorstoß: MDR und ein 24/7-Defense-Center

Die Argumente für den neuen, zubuchbaren MDR-Service stützen sich auf drastische Marktveränderungen. Laut dem CrowdStrike Global Threat Report 2026 erfolgen 82 Prozent aller Angriffe mittlerweile ohne klassische Schadsoftware, woran Standard-Antivirus-Programme oft scheitern. Baobabs Antwort darauf ist ein rund um die Uhr besetztes Security Operations Center (SOC). Die Ansagen des Start-ups sind selbstbewusst: Mit einer Erkennungsrate von 99 Prozent identifiziere man Bedrohungen bereits in der Entstehungsphase. Die hauseigene Deep-Scan-Technologie arbeite 3,2-mal effektiver als herkömmliche Scans, zudem liege die Angriffsfrequenz bei Bestandskund*innen um 77 Prozent unter dem Marktdurchschnitt. Ergänzt wird das Ganze durch Dark Web Monitoring.

Doch wie kann ein Start-up im Angesicht des globalen Fachkräftemangels in der Cybersecurity personell und technologisch mit staatlich finanzierten Hacker-Syndikaten mithalten? Klemm verweist auf das ambitionierte Umfeld: Weil das Team Kunden aktiv berate und nicht nur stumpf Risiken überwache, habe man sich als Top-Adresse für Talente etabliert. Gleichzeitig gibt er sich pragmatisch und räumt ein, dass man nicht alles allein stemmen kann: „Um personelle Spitzen abzufangen, kooperieren wir mit hochprofessionellen Technologiepartnern.“ Diese Hybridstrategie sichere die Skalierbarkeit und den Zugang zu führender Technologie. Das absolute Kernversprechen an den Kunden tastet er dabei jedoch nicht an: „Die Analyse und der direkte Kontakt bleiben immer bei uns.“

Genial verzahnt oder überhoben?

In der Theorie ist die Verknüpfung von aktiver Abwehr und Versicherung genial: Versagen die Abwehrmaßnahmen von Baobab, muss die Versicherung den finanziellen Schaden ohnehin tragen – die Interessen von Kund*in und Versicherer sind maximal synchronisiert. In der Praxis gleicht der Betrieb eines 24/7-SOC jedoch einem Hochseilakt, der extrem personal- und kostenintensiv ist. Zudem droht ein massives Klumpenrisiko, falls ein neuartiger Zero-Day-Exploit die Filterlogik umgeht und hunderte Mittelständlerinnen gleichzeitig kompromittiert werden.

Auf dieses „All-Eggs-in-One-Basket“-Szenario angesprochen, reagiert Klemm unaufgeregt und verweist auf die harten Realitäten der Branche: „In der Cybersecurity gibt es keine hundertprozentige Sicherheit. Daher stellt ein neuartiger Zero-Day-Exploit für die gesamte Branche grundsätzlich ein Kumulrisiko dar.“ Doch genau dieses Risiko trage man als Assekuradeur über die Policen ohnehin bereits. Der MDR-Service sei kein zusätzliches Risiko, sondern ein Schutzschild. „Anstatt die Gefahr zu vergrößern, reduziert unsere aktive Abwehr die Wahrscheinlichkeit, dass ein solches Ereignis überhaupt zum Tragen kommt“, argumentiert der Geschäftsführer. Und wenn alle Stricke reißen? „Die Versicherungspolice ist der finale Sicherheitsanker für den reinen Risikotransfer“, stellt er klar.

Markt & Wettbewerb: Kampf der Titanen

Im Mid-Market-Segment tritt das Berliner Team gegen globale Giganten wie Munich Re oder spezialisierte Cyber-MGAs wie das US-Einhorn Coalition an. Auch der Markteintritt US-amerikanischer Riesen in Europa beunruhigt Klemm nicht – im Gegenteil: „Der Markteintritt globaler Akteure unterstreicht vor allem eines: Das enorme Potenzial des europäischen Cybermarktes.“

Die Marschroute für die kommenden 12 bis 18 Monate ist klar gesteckt. Man wolle die Verzahnung von Vorfallsreaktion (Incident Response) und MDR weiter vertiefen und die Schadenquote weiter unter den Marktdurchschnitt drücken. Der entscheidende Hebel soll jedoch die Radikalvereinfachung des Versicherungsabschlusses werden. „Unser Ziel: Der Abschluss einer Cyberversicherung oder Vertrauensschadenversicherung muss so einfach werden wie nie zuvor – für Makler und Kunden“, verspricht Klemm. Gegen die übermächtige Konkurrenz will er nicht durch schiere Finanzkraft gewinnen: „Wir gewinnen diesen Wettbewerb nicht über das größte Marketingbudget, sondern über das beste Risikomanagement und die engste Partnerschaft mit dem Mittelstand.“

Für die Branche ist Baobab damit ein spannendes Lehrstück über die Vertikalisierung von Geschäftsmodellen. Schaffen es die Berliner, ihr technologisches Versprechen zu halten, bauen sie eine hochprofitable Cybersecurity-Festung für den europäischen Mittelstand. Scheitert die Technik jedoch an der Realität komplexer Cyberbedrohungen, droht das gesamte Modell unter den eigenen Schadensquoten zu kollabieren. Es bleibt ein riskantes, aber zukunftsweisendes Play.

Energie-Betriebssystem fürs Mehrfamilienhaus: Berliner Start-up VREY sichert sich 3,3 Millionen Euro Seed-Kapital

Das Climate-Tech-Start-up VREY sammelt eine Millionenfinanzierung ein, um sich als zentrales „EnergyOS“ für Vermieter*innen zu etablieren. Doch der Markt ist umkämpft und hält operative Tücken bereit.

VREY (rechtlich firmierend unter RE Joule GmbH ) hat den Abschluss einer Seed-Finanzierungsrunde in Höhe von 3,3 Millionen Euro bekannt gegeben. Angeführt wird die Runde von Rubio Impact Ventures. Als weitere Investor*innen steigen der High-Tech Gründerfonds (HTGF) sowie der Impact-Investor Kopa Ventures ein. Das frische Kapital soll in die Skalierung des aktuell rund 20-köpfigen Teams sowie in die Weiterentwicklung der eigenen Software-Plattform fließen.

Warum PV auf Mietshäusern bisher oft scheiterte

Solaranlagen auf Einfamilienhäusern sind längst ein Erfolgsmodell, doch auf Mehrfamilienhäusern galten sie lange als operativ komplex und wirtschaftlich wenig attraktiv. Der Hauptgrund: Vermieter*innen, die ihren Mieter*innen Strom vom eigenen Dach anbieten wollten, fielen beim klassischen Mieterstrom-Modell schnell in die Pflichten eines vollwertigen Energieversorgers. Sie mussten unter anderem eine Vollversorgung garantieren – also auch dann Reststrom einkaufen und liefern, wenn die Sonne nicht schien. Komplexe Abrechnungsprozesse und teure Messtechnik schreckten zusätzlich ab.

Mit der Einführung der „Gemeinschaftlichen Gebäudeversorgung“ (GGV) entfällt ein Großteil dieser Hürden, insbesondere die Notwendigkeit für Eigentümer*innen, selbst als Energieversorger*innen aufzutreten.

VREY als „EnergyOS“

Genau auf diese regulatorische Neuerung setzt VREY. Das Start-up kombiniert eine automatisierte Abrechnungssoftware mit der Zulassung als zertifizierter Messstellenbetreiber. VREY positioniert sich damit als eine Art Betriebssystem („EnergyOS“) für die Messung, Abrechnung und Steuerung von Energieflüssen im Mehrfamilienhaus.

Die Wertschöpfung ist in der Theorie für alle Parteien lukrativ:

- Vermieter*in: Eine typische 30-kWp-Anlage auf einem Zehn-Parteien-Haus kann laut VREY rund 5.500 Euro an zusätzlichen jährlichen Einnahmen generieren.

- Mieter*in: Bewohner*innen können ihren Strom bis zu 20 Prozent günstiger beziehen, was laut Unternehmensangaben jährlichen Einsparungen von etwa 120 bis 250 Euro entspricht.

Hohes Tempo seit Gründung

Gegründet wurde VREY im Jahr 2024 von Julius Pahmeier und Cedric Jaeger. Das Tempo des Gründerduos ist beachtlich: Laut Unternehmensangaben hat VREY bereits eine dreistellige Anzahl von Projekten in allen 16 Bundesländern umgesetzt. Die Kundschaft reicht von privaten Vermietern bis hin zu großen Immobilienunternehmen und Wohnungsbaugenossenschaften.

Flaschenhälse und Konkurrenzkampf

Der adressierbare Markt für VREY ist mit über 20 Millionen potenziellen Wohneinheiten in Deutschland enorm. Doch das Start-up bewegt sich keinesfalls im luftleeren Raum.

Der Wettbewerb: Die Marktchancen der GGV haben auch andere Player erkannt. Etabliertere Lösungsanbieter wie Einhundert Energie, Metergrid, Pionierkraft oder das zu Enviria gehörende prosumergy adressieren den Markt für dezentrale Energieversorgung teils seit Jahren mit eigenen Hard- oder Softwarelösungen. VREY muss in der Praxis beweisen, dass die eigene Plattform-Architektur der Konkurrenz langfristig überlegen ist.

Operative Hürden: Obwohl die gesetzlichen Rahmenbedingungen verbessert wurden, ist die Umsetzung oft steinig. Branchenverbände wie die Deutsche Gesellschaft für Sonnenenergie (DGS) kritisieren, dass die Umsetzung der GGV in Deutschland derzeit vielerorts an strukturellen Blockaden der klassischen, grundzuständigen Messstellenbetreiber scheitert. Es kommt zu Verzögerungen beim zwingend notwendigen Einbau intelligenter Messsysteme (Smart Meter).

VREY umgeht diesen Flaschenhals clever, indem das Unternehmen selbst als zertifizierter Messstellenbetreiber agiert und sich so autark von lokalen Netzbetreiber*innen macht. Dennoch bleibt eine zweite operative Hürde bestehen: Die Installation der Anlagen. Hier verlässt sich VREY auf lokale, frei wählbare Installationsbetriebe. Das Wachstum des Start-ups korreliert somit unweigerlich mit den Kapazitäten und dem anhaltenden Fachkräftemangel im deutschen Handwerk.

Fazit

VREY zeigt, wie Start-ups durch neue regulatorische Rahmenbedingungen Märkte erschließen können, die vorher als unprofitabel galten. Die Kombination aus Software-Abrechnung und der Lizenz als eigener Messstellenbetreiber ist ein starker USP, um bürokratische Trägheit zu umschiffen. Mit der soliden Seed-Finanzierung im Rücken hat das Team nun den nötigen Spielraum, um im Kampf um die deutschen Mietshaus-Dächer eine entscheidende Rolle einzunehmen – sofern die Koordination mit dem Handwerk reibungslos skaliert.

11 Mio. USD für VisioLab: Stürzt ein Osnabrücker Start-up die Kassen-Dinos?

Das Start-up VisioLab der Gründer an Tim Niekamp und Iwo Gernemann hat den Kassen-Dinos den Kampf angesagt, in dem es den Checkout in Mensen und Arenen durch simple iPad-KI automatisiert.

In der Systemgastronomie, in Mensen und Stadien ist der größte Engpass oft nicht die Küche, sondern die Kasse. Das Osnabrücker Start-up VisioLab adressiert dieses Problem mit künstlicher Intelligenz und verwandelt handelsübliche iPads in voll funktionsfähige Self-Checkout-Systeme. Für die weitere globale Skalierung hat das Unternehmen nun eine Series-A-Finanzierung in Höhe von 11 Millionen US-Dollar abgeschlossen. Angeführt wird die Runde von eCAPITAL Entrepreneurial Partners und Simon Capital, unterstützt von bestehenden Investor*innen wie dem High-Tech Gründerfonds, APX, dem Family Office zwei.7 und Business Angels wie Jens Ohr. Doch wie robust ist dieses scheinbar simple Geschäftsmodell im hart umkämpften Markt der Kassenautomatisierung wirklich?

Aus der Mensa in die NBA: Die Köpfe hinter dem Kassen-Killer

Gegründet wurde VisioLab im Jahr 2019 in Osnabrück von CEO Tim Niekamp und President & COO Iwo Gernemann. Die Idee entsprang einem stark spürbaren Schmerzpunkt in der Gastronomie: Zur Mittagszeit oder in der Halbzeitpause stauen sich die Gäste, während herkömmliche Kassensysteme oft im fünfstelligen Preisbereich liegen und aufwendig geschultes Personal erfordern. Zudem verschärft der chronische Personalmangel in der Foodservice-Branche die Lage massiv.

Die Vision der Gründer war von Beginn an, den Checkout-Prozess durch KI so drastisch zu vereinfachen, dass die zugrundeliegende Technologie im Betrieb kaum noch als solche wahrgenommen wird. Mit einem aktuellen Team von rund 25 Mitarbeitern an den Standorten Osnabrück und Boston haben Niekamp und Gernemann das System iterativ zur Marktreife geführt und internationalisiert. Das frische Kapital soll nun genutzt werden, um das Team auf etwa 40 Mitarbeiter auszubauen – gezielt verstärkt durch ehemalige Führungskräfte von Klarna, SumUp und Google.

Ein iPad als Kassensystem: Geniestreich oder Achillesferse?

Die technische Umsetzung besticht durch Hardware-Minimalismus. VisioLab eliminiert teure, proprietäre Scanner-Kassen und setzt stattdessen auf ein Apple iPad samt Kamera, kombiniert mit einem kompakten Bluetooth-Bezahlterminal und der eigenen KI-App. Die KI erkennt Speisen und Getränke auf dem Tablett in Echtzeit – unabhängig davon, ob diese verpackt oder lose sind. VisioLab vertreibt dieses Setup als "Plug-and-Play"-Lösung direkt als E-Commerce-Produkt über einen Online-Shop. Ein einziges Foto genügt laut Unternehmensangaben, um der KI ein neues Produkt beizubringen, wodurch das System in weniger als fünf Minuten startklar sein soll.

Die fundamentalen Zahlen belegen, dass diese Strategie derzeit voll aufgeht:

- Transaktionen: Weltweit verarbeiten rund 500 Installationen etwa eine Million Transaktionen im Monat.

- Gesamtvolumen: Das kumulierte Transaktionsvolumen liegt mittlerweile bei knapp 100 Millionen US-Dollar.

- Wirtschaftlichkeit: Im vergangenen Quartal verzeichnete das Unternehmen erstmals einen positiven Cashflow.

Kritisch hinterfragt

Der Verzicht auf stark spezialisierte Hardware ist ein zweischneidiges Schwert. Einerseits ermöglicht es VisioLab eine enorme Vertriebsgeschwindigkeit ohne große Hardware-Vorfinanzierungen und langwierige Installationen. Andererseits ist die rein kamerabasierte 2D-Erkennung auf einem handelsüblichen Tablet potenziell anfällig für komplexe Lichtverhältnisse oder optisch nahezu identische Gerichte. Zudem begibt sich das Start-up in eine absolute Abhängigkeit vom Apple-Ökosystem. Das Geschäftsmodell erfordert eine konstante technologische Weiterentwicklung, um die "Churn-Rate" (Kund*innenabwanderung) gering zu halten, da die Wechselkosten für Gastronom*innen bei einer reinen iPad-Lösung verhältnismäßig niedrig sind.

Der Kampf um die Food-Erkennung

Der globale Markt für "AI Food Recognition" und Self-Checkout erlebt derzeit einen massiven Schub. VisioLab hat sich in diesem Umfeld geschickt in lukrativen, hochfrequentierten Nischen positioniert:

- Sport & Entertainment: In den USA stattet VisioLab beispielsweise die Arena des NBA-Teams Orlando Magic mit 43 Systemen aus und deckt damit fast das gesamte Stadion ab. Weitere Kunden sind die NFL-Teams Atlanta Falcons und Carolina Panthers sowie der Fußballclub Inter Miami.

- Bildung & Corporate: Etwa jeder dritte deutsche Uni-Campus nutzt die Technologie über die Studierendenwerke. Hinzu kommen Betriebskantinen von DAX-Konzernen und Kooperationen mit globalen Caterern wie der Compass Group und Aramark.

Allerdings agiert VisioLab nicht konkurrenzlos. Der Wettbewerb ist technologisch divers und hochkapitalisiert. Das US-Start-up Mashgin gilt als einer der härtesten globalen Konkurrenten. Im Gegensatz zu VisioLab setzt Mashgin auf spezielle Kiosk-Terminals mit multiplen 3D-Kameras. Das erhöht zwar die Hardwarekosten und den Installationsaufwand drastisch, verspricht aber eine extrem hohe Erkennungsgenauigkeit selbst bei chaotischen Objektanordnungen. Auch auf dem Heimatmarkt gibt es mit Start-ups wie auvisus ("VisionCheckout") starke Wettbewerber*innen, die ebenfalls KI-Bilderkennung für Betriebsrestaurants und Kantinen anbieten.

Fazit: Hyperwachstum mit Haken

Für die Start-up-Szene liefert VisioLab ein beeindruckendes Beispiel dafür, wie kluges "Go-to-Market"-Design aussieht. Anstatt den kapitalintensiven Weg proprietärer Hardware-Entwicklung zu gehen, nutzt das Team Standard-Consumer-Hardware und fokussiert die gesamte Wertschöpfung auf die smarte KI-Software am Endgerät.

Diese agile Entscheidung ermöglicht das derzeitige Hyperwachstum: Das US-Geschäft steuert bereits rund 50 Prozent zum Umsatz bei und wächst jährlich um über 1.000 Prozent. Mit dem frischen Kapital, dem Ausbau des US-Standorts durch Co-Founder Iwo Gernemann sowie der gezielten Expansion nach Australien, Neuseeland, Österreich, Großbritannien und in die Niederlande stellt VisioLab die Weichen auf globale Skalierung.

Ob das Osnabrücker Start-up langfristig gegen bestens finanzierte US-Giganten und 3D-Kamera-Spezialisten bestehen kann, wird sich an der Robustheit der Software im massenhaften Dauerbetrieb zeigen. Gelingt es VisioLab, durch kontinuierliches KI-Training seinen Genauigkeits- und "Plug-and-Play"-Vorteil auszubauen, hat das Team hervorragende Chancen, den Checkout-Prozess in der Systemgastronomie dauerhaft zu dominieren.

UniteLabs: Der Münchner DeepTech-Herausforderer auf dem Weg zum globalen Labor-Standard?

Das 2024 von Robert Zechlin, Lukas Bromig und Julian Willand gegründete UniteLabs will die Laborautomatisierung von proprietären Hürden befreien. Nach einer Millionenfinanzierung folgte Anfang 2026 der offizielle US-Launch. Wir wollten wissen: Wie realistisch ist die Vision eines herstellerunabhängigen Standards in einem von Hardware-Silos dominierten Markt? Eine Analyse.

Wer heute ein hochmodernes BioTech-Labor betritt, erwartet nahtlos vernetzte HighTech-Forschung. Die Realität sieht oft anders aus: Rund 90 Prozent der Laborgeräte stammen von unterschiedlichen Hersteller*innen und sprechen schlichtweg nicht dieselbe technische Sprache. Um künstliche Intelligenz in der Forschung nutzbar zu machen, müssen hochqualifizierte Wissenschaftler*innen oft als Software-Ingenieur*innen einspringen und mühsam Schnittstellen programmieren. Genau diesen Flaschenhals will das Münchner DeepTech-Start-up UniteLabs beseitigen.

Die Gründer und der Sprung aus München

Hinter UniteLabs stehen Robert Zechlin, Lukas Bromig und Julian Willand. Nach Vorarbeiten ab 2022 wurde das Unternehmen 2024 offiziell gegründet. Das Team vereint interdisziplinäre Expertise aus Chemieingenieurwesen, Wirtschaftsinformatik und Unternehmensstrategie – eine essenzielle Mischung für ein Produkt, das tiefes Prozessverständnis mit modernster Softwarearchitektur verbinden muss.

Dass die Idee einen massiven Schmerzpunkt der Industrie trifft, zeigt die rasante Entwicklung der letzten Monate. Nach einer Pre-Seed-Finanzierungsrunde in Höhe von 2,77 Millionen Euro unter der Führung von NAP (ehemals Cavalry Ventures) im Januar 2025 und der Auszeichnung als „Bestes Münchner Start-up“ beim Munich Startup Award 2025 ist das Unternehmen sichtlich gewachsen. Im ersten Quartal 2026 zählt das Team im Münchner Inkubator Werk1 bereits rund 28 Köpfe.

Doch wie verhindert ein derart rasant wachsendes Team, bei der ständigen Anbindung neuer, exotischer Hardware nicht zu einer hochbezahlten IT-Manufaktur zu verkommen? Schließlich erfordert jedes neue Laborgerät auf dem Markt zunächst einmal Entwicklungsaufwand für den passenden Konnektor.

„Unser Ziel ist nicht, jedes exotische Gerät einzeln ‚irgendwie‘ anzubinden“, stellt Mitgründer Robert Zechlin klar. Vielmehr soll die Integration zu einer wiederholbaren Produktfähigkeit reifen. Statt sich im Klein-Klein der Modellnummern zu verlieren, baue UniteLabs seine Konnektoren entlang grundsätzlicher Geräte-Fähigkeiten. Die puren Herstellerspezifika landen dabei in einer dünnen Adapter-Schicht, während Workflows und Datensemantik konsistent bleiben.

Um die berüchtigte Skalierungsfalle zu umgehen, setzt das Start-up zudem verstärkt auf „Reusable Automation Assets“. „Wir investieren in validierte Workflow-Bausteine, Device-Profile und Test-Suites, mit denen die zweite und dritte Integration deutlich schneller wird als die erste“, betont Zechlin und skizziert damit den Weg zum echten SaaS-Unternehmen. Der Gründer gibt die Richtung selbstbewusst vor: „Die Grenzkosten für das nächste Gerät und den nächsten Standort müssen über Zeit sinken. Unser Endzustand ist ein Ökosystem, in dem Integrationen gemeinsame Infrastruktur sind, nicht Projektgeschäft.“

Vom Prototyp zur Architektur der offenen Labore

Im Februar 2026 hat UniteLabs auf der renommierten Branchenmesse SLAS in Boston den offiziellen US-Launch seines „AI-Ready Lab Automation Systems“ vollzogen. Statt nur isolierte Schnittstellen zu flicken, positioniert sich das Start-up nun mit einer klaren, dreiteiligen Architektur.

Den Kern bildet die Cloud-native „UniteLabs Platform“, die Hardware vernetzt und die Integration von Machine-Learning-Modellen in Echtzeit erlaubt. Ergänzt wird dies durch die lokale Anwendung „GroundControl“ für den Plug-and-Play-Anschluss von Geräten sowie das „UniteLabs SDK“. Letzteres ist ein Python-Werkzeug für Wissenschaftler*innen, um Labor-Workflows komplett als Code zu steuern. Dass diese Theorie praxistauglich ist, beweist das aufstrebende KI-BioTech-Unternehmen Cradle, das die Lücke zwischen Maschinen und digitalen Daten-Lakes intern bereits mit dem Münchner System schließt. Laut UniteLabs soll sich der Labor-Durchsatz für solche KI-getriebenen Forschungsteams durch die Plattform um bis zu das Vierfache steigern lassen.

Ein „Lab-as-Code“-Ansatz via Python mag für entwickleraffine Data Scientists verlockend sein – doch schließt er nicht paradoxerweise die klassischen Biolog*innen aus, für die Code-Workflows oft eine zu steile Lernkurve bedeuten?

„Code ist nicht das Produkt“, kontert Zechlin. Er sei vielmehr eine Schnittstelle, die sowohl Power-User als auch den Laboralltag bedienen müsse. Das SDK richte sich an Teams, die volle Kontrolle über Versionierung und automatisierte Tests verlangen – was im KI-BioTech-Umfeld zunehmend Standard sei. Zechlin räumt jedoch ein, dass das Programmieren nicht jedem liege: „Die meisten wollen zuverlässige Ausführung und klare Transparenz.“

Die Lösung der Münchner: Über die Orchestrierungsschicht und „GroundControl“ werden Workflows paketiert und mit Leitplanken versehen, sodass sie auch für Nicht-Entwickler sicher ausführbar sind. Code bleibt strategisch zwar die „universelle Abstraktion“ über Geräte hinweg, doch das Interface der Zukunft sieht anders aus. Zechlin blickt voraus: „Das User Interface für Wissenschaftler wird zunehmend KI-gesteuert und natürliche Sprache zum primären Interface. UniteLabs dient diesen KI-Applikationen als robuste Surface Area und Source of Truth.“ Die Leitplanke für das Wachstum fasst er in einem Satz zusammen: „Unsere Vision ist: flexibel, wo es Sinn macht, und kompromisslos robust, wo es zählen muss.“

Die Bewährungsprobe auf dem US-Markt

Nach dem Bostoner Launch steht das Start-up nun vor der monumentalen Aufgabe, sich im hochkompetitiven US-Markt zu behaupten. Hier entscheidet sich, ob UniteLabs vom europäischen Hoffnungsträger zum globalen Player reift. Umgeben von gigantischen Investitionen in die KI-Wirkstoffentwicklung reicht es nicht, nur ein weiteres Automatisierungstool zu sein – UniteLabs muss sich als essenzieller „Schaufelhersteller“ für den aktuellen Boom etablieren.

Dabei trifft man auf amerikanische Wettbewerber*innen, die teils mit hunderten Millionen Dollar Venture Capital ausgestattet sind. Wie überlebt ein Münchner Start-up mit einer Pre-Seed-Runde von knapp drei Millionen Euro diese Materialschlacht? Zechlin gibt sich pragmatisch und weicht dem direkten Finanz-Vergleich aus: „Klar: In Infrastrukturmärkten hilft Kapital, aber es ist nicht der entscheidende Hebel.“ Anstatt die Konkurrenz im reinen „Spend“ schlagen zu wollen, baue man auf messbaren Nutzen im Laborbetrieb.

Der Plan scheint aufzugehen: Ein Großteil von Umsatz und Pipeline stammt heute bereits aus den USA, wo UniteLabs Kund*innen an beiden Küsten bedient und mit großen Hardware-Hersteller*innenn kooperiert. „Wir planen für dieses Jahr unseren ersten Big Pharma Roll-out, der sowohl in Europa als auch an Standorten in den USA erfolgen soll“, verrät der Gründer. Um diese Dynamik zu finanzieren, hebe man aktuell eine 9-Millionen-Euro-Seed-Runde für die US-Expansion. Den strukturellen Wettbewerbsvorteil sieht Zechlin in der herstelleragnostischen Verbindung bestehender Geräte: „Statt Rip-and-Replace zu verlangen, werden Workflows schneller produktiv, Daten werden sauber mit Kontext versehen, und Teams können ‚Lab-as-Code‘ wirklich ausrollen.“

Ein strategischer Hebel ist dabei die Zielgruppenansprache. Statt in endlosen Vertriebszyklen mit dem C-Level großer Pharma-Konzerne zu ringen, treibt UniteLabs ein nutzer*innengetriebenes Wachstum voran. Labor-Ingenieur*innen, die durch das Python-SDK wochenlange Schnittstellenprogrammierung einsparen, tragen das System organisch in ihre Unternehmen. Dabei profitiert das Start-up enorm davon, selbst keine Pipettierroboter oder Analysegeräte herzustellen. Als „neutrale Schweiz“ der Labor-Hardware buhlt UniteLabs nicht um lukrative Geräteverkäufe – ein extrem starkes Argument gegen den gefürchteten Vendor-Lock-in amerikanischer Hardware-Giganten.

Stresstest für das Geschäftsmodell und Regularien

Doch die ambitionierte Plattform-Strategie wird kritisch geprüft werden. Das Geschäftsmodell birgt ein ständiges API-Katz-und-Maus-Spiel, da Schnittstellen zu teils stark abgeschirmten Systemen gebaut werden müssen. Wenn etablierte Hersteller*innen ihre Firmware ändern oder Drittanbieter-Zugriffe blockieren, explodieren schnell die Wartungskosten für die Konnektoren.

Bleibt die Frage an den Gründer: Was ist also der Plan B, wenn die Marktführer ihre Schnittstellen per Update plötzlich aktiv verschlüsseln? Reicht der Verweis auf offene Standards wie das SiLA2-Protokoll in der harten Praxis aus?

„Wir gehen davon aus, dass Hersteller ihre Ökosysteme schützen werden. Unsere Strategie darf deshalb nicht auf ‚Goodwill‘ bauen“, gibt sich Zechlin keinen Illusionen hin. Standards wie SiLA2 seien zwar hilfreich gegen Fragmentierung, aber „kein Schutzschild“. Der Ansatz der Münchner ist stattdessen pragmatisch und mehrstufig: Standards nutzen, wo verfügbar, und eigene robuste Adapter bauen, wo nötig. Zudem betreibe man ein Programm mit automatisierten Regressionstests am realen Geräteverhalten, um Fehler durch Updates früh zu erkennen.

Der zweite Baustein der Verteidigung ist kommerzieller Druck. Da Labore zunehmend „Best-of-Breed“-Lösungen kombinieren wollen, würden Hersteller, die Interoperabilität blockieren, zunehmend Deals riskieren. Im Hintergrund investiere man deshalb viel Arbeit in aktiv gepflegte Partnerschaften mit den Produzent*innen. Zechlins Plan B lautet letztlich Resilienz: „Mehrere Integrationspfade, starke Tests, und ein System, das stabil bleibt, auch wenn sich die Oberfläche verändert.“ Er ist sich sicher: „Langfristig wirkt die Ökonomie in Richtung Offenheit.“

Neben blockierender Hardware bleibt die US-Zulassungsbehörde FDA die vielleicht höchste Hürde auf dem Weg in den Enterprise-Markt. Deren strenge Vorgaben zu elektronischen Aufzeichnungen sind der größte Vorbehalt von Pharmaunternehmen gegenüber Cloud-basierten Systemen. Gelingt es UniteLabs, Offenheit mit lückenlosen Audit-Trails zu verknüpfen, könnten sie die berüchtigten Sales-Zyklen drastisch verkürzen.

Doch wie passt maximale Entwickler*innen-Freiheit durch Python-Skripte mit rigider FDA- und GxP-Compliance zusammen? Für Zechlin existiert dieser Widerspruch im Labor-Alltag schlichtweg nicht: „Compliance widerspricht Flexibilität nicht. Was widerspricht, ist unkontrollierte Veränderung.“

Um Big Pharma gerecht zu werden, behandle man hochflexible Workflows wie reguläre Software-Produkte: versioniert, testbar und auditierbar. „Ein Script ist in einem GxP-Kontext kein ‚jeder macht, was er will‘, sondern ein kontrolliertes Artefakt mit definierten Inputs, erwarteten Outputs und einem Validierungsnachweis“, unterstreicht der Mitgründer. Die Plattform trenne Sandbox-Entwicklungen von einer strikt kontrollierten Produktionsebene mit signierten Releases, Environment-Pinning und klarer Datenlineage. Zechlin formuliert einen selbstbewussten Anspruch an die Branche: „Das Labor holt Software-Best-Practices nach. Unser Anspruch ist, ‚compliant by design‘ zur Default-Einstellung für AI-ready Lab Ops zu machen.“

Fazit

UniteLabs hat exzellentes Timing bewiesen. Die BioTech-Branche lechzt nach KI, scheitert aber noch massenhaft an isolierten Daten. Durch das Bereitstellen essenzieller Daten-Infrastruktur haben sich die Münchner in eine starke Ausgangsposition manövriert. Der US-Launch und anstehende Messepräsentationen zeugen vom Anspruch der Gründer. Der ultimative Lackmustest ab 2026 wird jedoch sein, ob die Hardware-Hersteller*innen diesen Wandel dulden – oder den Kampf um ihre lukrativen Software-Margen eröffnen.

Bleibt die Frage nach dem viel zitierten „Endgame“: Baut das Start-up wirklich das globale Betriebssystem für Biotech-Labore, oder macht man sich letztlich nur als hochattraktives Übernahmeziel für Hardware-Giganten hübsch?

Auf diese Entweder-Oder-Frage antwortet Zechlin diplomatisch, aber ambitioniert: „Unsere Vision ist, die neutrale Betriebsschicht für moderne Labore zu werden, weil die Branche einen herstellerunabhängigen Standard braucht, nicht noch ein weiteres Einzellösungstool.“ Gleichzeitig sei man Realist: Infrastruktur zähle nur, wenn sie im Alltag zuverlässig genutzt werde und verlässliche, strukturierte Daten für KI liefere.

Sollte das gelingen, hält sich UniteLabs alle Optionen offen – von der unabhängigen Kategorie-Definition über strategische Partnerschaften bis hin zum Exit. Doch auf einen schnellen Verkauf schiele man nicht, verspricht Zechlin: „Wir bauen nicht für eine Übernahme. Wir bauen so, dass der Markt die Plattform ernst nehmen muss.“ Und am Ende solle ohnehin der/die Kund*in profitieren: „Weniger Silos, schnellere Science, und ein Ökosystem, in dem Innovation nicht an proprietären Schnittstellen hängen bleibt.“

Synera sichert sich 35 Mio. Euro für die Revolution des Engineerings

Was einst als bionisches Forschungsprojekt begann, ist heute eine der vielversprechendsten europäischen DeepTech-Hoffnungen. Doch wie tragfähig ist die Vision vom „autonomen digitalen Ingenieur“ im stark regulierten Maschinenbau? Ein tieferer Blick auf Gründer, Markt und das Geschäftsmodell.

Die deutsche Industrie steht unter massivem Druck: Internationale Konkurrenz – insbesondere aus Asien –, chronischer Fachkräftemangel und die Notwendigkeit, Entwicklungszyklen drastisch zu verkürzen, zwingen zum Handeln. Generative künstliche Intelligenz (GenAI) gilt als Heilsbringer, doch in der Praxis verpuffen viele Initiativen. Nur etwa 41 Prozent der KI-Prototypen in der Fertigungsindustrie erreichen laut Branchenstudien den produktiven Einsatz. Die Konstruktions- und Entwicklungsabteilungen gelten als stark in Silos organisiert und bis heute schwer automatisierbar.

„Engineering ist das Rückgrat jedes Industrieunternehmens, gehört jedoch nach wie vor zu den am wenigsten digitalisierten und automatisierten Funktionen und war bis vor Kurzem für KI weitgehend unzugänglich“, bringt es Dr. Moritz Maier, Co-CEO von Synera, auf den Punkt.

Genau in diese Lücke stößt sein Unternehmen. Mit einer Series-B-Finanzierungsrunde über 35 Millionen Euro will das Bremer Startup nun international skalieren. Angeführt wird die Runde vom europäischen Wachstumsfonds Revaia, mit starker Beteiligung des UVC Partners Wachstumsfonds sowie Capgemini (über ISAI Cap Ventures). Auch die Bestandsinvestoren Spark Capital, BMW iVentures und Cherry Ventures ziehen wieder mit. Das Signal an den Markt ist deutlich: Engineering Automation wird zum nächsten großen Software-Schlachtfeld.

Von Kieselalgen zur KI-Plattform

Hinter Synera stehen die Gründer Moritz Maier, Daniel Siegel (beide Co-CEO) und Sebastian Möller (Managing Director). Die Ursprungsidee entstand am renommierten Alfred-Wegener-Institut (AWI) in Bremerhaven. Die Gründer forschten dort im Bereich der Bionik und untersuchten die Leichtbaustrukturen von Kieselalgen, um deren evolutionäre Prinzipien auf technische Bauteile zu übertragen.

Aus „Evolutionary Light Structure Engineering“ wurde 2018 die Ausgründung ELISE. Zunächst lag der Fokus auf algorithmusbasiertem Design. Mit der Zeit erkannten die Gründer jedoch ein viel grundlegenderes Problem: Es fehlte nicht an Software für das eigentliche Design, sondern an einer Brücke, die die unzähligen Insellösungen (CAD, Simulation, Materialprüfung) im Engineering-Alltag verbindet. Dies führte zur Neuausrichtung und schließlich zur Umbenennung in Synera – einer Low-Code- und KI-Plattform für Connected Engineering.

Das Geschäftsmodell im Check

Synera betreibt ein klassisches B2B-Plattform-Modell. Anstatt etablierte Platzhirsche im Computer-Aided Design (CAD) zu verdrängen, positioniert sich Synera als übergeordnete Orchestrierungsschicht. Die Software klinkt sich in über 80 bestehende Tools ein.

- Der Werttreiber: Nutzer*innen können komplexe Workflows (z. B. CAD-Modellierung → Simulation → Kostenkalkulation → Designanpassung) als Templates speichern. Das frische Kapital soll laut Moritz Maier nun eine Entwicklung beschleunigen, „bei der KI-Agenten als echte digitale Engineers agieren und komplexe Workflows entlang der gesamten Wertschöpfungskette autonom ausführen.“

- Der Lock-in-Effekt: Wenn ein Industriekonzern seine Kernprozesse auf Synera automatisiert hat, ist die Plattform kaum noch auszutauschen. Die Wechselkosten für den Kunden sind enorm.

- Die Herausforderungen: Das Modell ist technisch hochkomplex. Die ständige Pflege von über 80 API-Schnittstellen zu Drittanbietern bindet gewaltige Entwickler*innen-Ressourcen. Zudem erfordert der Vertrieb in klassische Hardware-Unternehmen lange Sales-Zyklen.

Zwischen RPA und Spezial-CAD

Wettbewerbsumfeld | Marktansatz | Syneras Differenzierung |

Generatives Design (z. B. nTop, Altair) | Fokus auf die Erstellung hochkomplexer, gewichtsoptimierter Bauteile. | Synera generiert nicht nur das Design, sondern automatisiert den Prozess quer durch verschiedene externe Tools. |

Klassische RPA (z. B. UiPath, Zapier) | Hervorragend für kaufmännische Prozesse (HR, CRM, Rechnungen). | Standard-RPA scheitert an den komplexen 3D-Geometrie- und Physikdaten des Engineerings. |

PLM-Systeme (z. B. Siemens, Dassault) | Verwalten den gesamten Produktlebenszyklus und die Daten. | Synera setzt sich auf diese oft schwerfälligen Systeme, um die agilen Arbeitsschritte flexibler zu machen. |

Kritische Einordnung: Vertraut der/die Ingenieur*in der KI?

Synera verweist auf eine Umsatzverdopplung im vergangenen Jahr und über 60 namhafte Kunden, darunter BMW, Airbus, NASA und Miele. Mit dem frischen Kapital steht die Expansion nach Asien, Europa und in die USA an. Dass dieser Wachstumskurs von den Investoren aktiv gestützt wird, betont Benjamin Erhart, General Partner bei UVC Partners: „Wir konnten erleben, wie Synera als zuverlässiger Partner die Transformation des Engineerings gestaltet.“

Doch der Weg zur breiten Durchdringung birgt auch Stolpersteine:

- Das Vertrauensproblem: „Agentic AI“ bedeutet, dass die Software eigenständig Entscheidungen trifft. In sicherheitskritischen Branchen (Luftfahrt, Automotive) herrschen jedoch strikte Compliance-Regeln. Bevor ein KI-Agent autonome Designänderungen an tragenden Bauteilen vornimmt, müssen massive Haftungsfragen geklärt sein.

- Die Pilot-Falle: Viele GenAI-Projekte scheitern auf dem Weg in die Produktion. Die Gefahr für Synera besteht darin, in Innovationsabteilungen stecken zu bleiben, während das operative Kerngeschäft aus Kostengründen an bewährten Methoden festhält.

- Die API-Abhängigkeit: Wer als Brückenbauer*in zwischen Dutzenden Software-Silos agiert, macht sich von den Anbietern abhängig. Sperrt ein großer CAD-Anbieter seine API, trifft dies Syneras Modell im Kern.

Fazit

Synera ist ein exzellentes Beispiel dafür, wie aus akademischer Grundlagenforschung ein hoch skalierbares DeepTech-Produkt werden kann. Der strategische Pivot vom reinen Design-Tool zur prozessübergreifenden Plattform zahlt sich durch die starke Series B nun aus. Gelingt es den Bremern, den eher konservativen globalen Maschinenbau davon zu überzeugen, dass KI-Agenten die menschlichen Ingenieur*innen nicht ersetzen, sondern befähigen, könnte Synera der entscheidende globale Standard im Connected Engineering werden.

Peak Quantum sichert sich 2,2 Mio. Euro für fehlerresistente Qubits

Peak Quantum holt 2,2 Mio. Euro für fehlerresistente Qubits. Wie das Münchner Spin-off mit EU-Förderung gegen die hochgerüstete Konkurrenz antritt.

München wächst weiter als Europas Quanten-Hauptstadt. Das Start-up Peak Quantum schließt seine Pre-Seed-Runde mit 2,2 Millionen Euro ab und positioniert sich im hart umkämpften Deep-Tech-Markt. Der Pitch der Gründer: Fehlerkorrektur direkt in der Hardware. Doch in einem extrem kapitalintensiven Umfeld reicht Geld allein nicht. Wie das Spin-off mit einem cleveren Infrastruktur-Schachzug gegen die hochgerüstete europäische Konkurrenz bestehen will.

Aus der Forschung in die Praxis

Im Jahr 2024 entstand Peak Quantum als Spin-off aus der Forschungsgruppe von Prof. Stefan Filipp am Walther-Meißner-Institut (WMI), das zur Bayerischen Akademie der Wissenschaften gehört. Das Gründungsteam deckt interdisziplinär die gesamte Wertschöpfungskette vom Chipdesign bis zur Systemintegration ab. Zu den Köpfen hinter der Unternehmung gehören Leon Koch (CEO), Alexander Schult (CFO), Dr. Thomas Luschmann (COO), Dr. Max Werninghaus (CSO), Ivan Tsitsilin (Head of Design), Kedar Honasoge (Head of Production) und Daniil Bazulin (Quantum Engineer). Unterstützt wird das junge Unternehmen durch wichtige Säulen des lokalen Ökosystems wie dem Munich Quantum Valley und der UnternehmerTUM.

„Hardware-First“ statt Software-Pflaster

Das aktuell größte Hindernis im Quantencomputing ist das sogenannte Rauschen – die enorme Fehleranfälligkeit der Recheneinheiten (Qubits). Während die Industrie bisher stark darauf setzte, schlicht die Anzahl physikalischer Qubits hochzuskalieren und Fehler nachträglich per Software zu korrigieren, wählt Peak Quantum einen grundlegend anderen Weg. Das Start-up entwickelt supraleitende Prozessoren, deren physikalische Architektur Fehler bereits auf der reinen Hardware-Ebene unterdrückt. Dieser integrierte Fehlerschutz soll die Komplexität des Gesamtsystems drastisch senken und die Entwicklung kommerziell nutzbarer Rechner massiv beschleunigen.

Das Geschäftsmodell & der EU-Infrastruktur-Hebel

Quanten-Hardware ist ein unfassbar teures Pflaster. Mit dem frischen Kapital von Investor*innen wie dem britischen Lead-Investor Cloudberry Ventures, United Founders oder QAI Ventures steigt die Gesamtfinanzierung von Peak Quantum auf gut fünf Millionen Euro. Für den Aufbau eigener Reinräume (CapEx) reicht das kaum. Der strategische Clou des Geschäftsmodells liegt daher in der europäischen Vernetzung: Peak Quantum bezieht öffentliche Fördermittel aus dem EU Chips Act und wurde ausgewählt, die im April 2026 startende Quantenchip-Pilotlinie SUPREME zu betreiben.

Ziel ist es, in Europa eine skalierbare Produktionsumgebung zu etablieren, die langfristig auch für externe Partner geöffnet werden soll. Ein Modell, das es Peak Quantum erlaubt, trotz einer frühen Finanzierungsphase hocheffizient an industrietauglichen Chips zu feilen.

Der Markt & die Konkurrenz

Doch der Markt verzeiht keine Verzögerungen, und München ist längst ein Haifischbecken der Quantentechnologie. Direkt vor der Haustür sitzen Schwergewichte:

- IQM Quantum Computers: Der europäische Platzhirsch für supraleitende Quantencomputer (mit Hauptsitz in Finnland, aber großem Zentrum in München), der kürzlich eine SPAC-Fusion für einen geplanten Milliarden-Börsengang ankündigte.

- planqc: Ein weiteres Münchner Spin-off, das auf neutrale Atome setzt und bereits 2024 eine Series A in Höhe von satten 50 Millionen Euro abschloss.

- Alice & Bob: Auf internationaler Ebene steht besonders das französische Start-up Alice & Bob in direkter technischer Konkurrenz. Die Pariser entwickeln sogenannte Cat Qubits, die ebenfalls hardwareseitig fehlerresistent sind, und kooperieren dabei bereits eng mit Microsofts Quanten-Sparte.

Fazit: Risiko und enorme Chance

Das Board rund um einen ehemaligen Alphabet-X-Advisor sieht in Peak Quantum ein elementares Puzzleteil für ein eigenständiges europäisches Quanten-Ökosystem. Die Investition ist ein klassisches „Deep-Tech-Infrastruktur-Play“.

Dennoch ist eine Pre-Seed-Runde von 2,2 Millionen Euro im Jahr 2026 angesichts der Kapitalausstattung der Konkurrenz eine riskante Wette. Peak Quantum muss durch den Zugang zur SUPREME-Pilotlinie extrem schnell beweisen, dass die fehlerresistente Architektur industriell skaliert und nicht nur im Labor des WMI funktioniert.

Bringt das Team um Leon Koch erste greifbare Pilotprojekte mit Forschungs- und Industriepartnern in den Bereichen Materialforschung, Logistik oder industrieller Optimierung zum Laufen, könnte Peak Quantum zu einem technologischen Flaschenhals werden, an dem in Europa niemand mehr vorbeikommt. Es ist das Paradebeispiel dafür, wie smarte Gründer*innen nicht nur Code oder Hardware schreiben, sondern das System aus Fördergeldern, Pilotlinien und lokaler Forschungsexzellenz maximal zu ihrem Vorteil hebeln.

50 Mio. US-Dollar-Series A-Runde für Berliner FinTech Midas

Das 2024 von Dennis Dinkelmeyer, Fabrice Grinda und Romain Bourgois gegründete Web3-Start-up Midas sammelt 50 Mio. $ ein, um tokenisierte Vermögenswerte sofort liquide zu machen. Das frische Kapital soll primär in die Entwicklung und Skalierung der sogenannten Midas Staked Liquidity (MSL) fließen.

Der Markt für tokenisierte Vermögenswerte (Real World Assets, kurz RWA) wächst rasant, leidet jedoch noch immer an einer strukturellen Hürde: Während Kryptomärkte rund um die Uhr in Echtzeit handeln, sind traditionelle Finanzprodukte im Hintergrund oft an klassische, mehrtägige Abwicklungszyklen gebunden. Wenn Investor*innen ihre Token in liquide Mittel zurücktauschen wollen, kommt es unweigerlich zu Verzögerungen. Genau diese Lücke will das Berliner FinTech Midas nun schließen und hat dafür massiv Kapital aufgenommen.

Wie das Unternehmen heute mitteilte, flossen in einer Series-A-Finanzierungsrunde 50 Millionen US-Dollar (rund 46 Millionen Euro). Angeführt wird die Runde von den Venture-Capital-Firmen RRE Ventures und Creandum. Zu den weiteren Geldgebern zählen namhafte Branchengrößen wie Framework Ventures, Coinbase Ventures sowie der traditionelle Vermögensverwalter Franklin Templeton, der selbst bereits stark im Bereich tokenisierter Anlageprodukte aktiv ist. Mit der aktuellen Runde steigt das Gesamtfinanzierungsvolumen des Start-ups auf knapp 59 Millionen US-Dollar.

Das Gründerteam aus TradFi und Web3

Hinter Midas, das 2024 gegründet wurde, steht ein Team, das tiefes Wissen aus der traditionellen Finanzwelt (TradFi), dem Venture Capital und dem dezentralen Finanzsektor (DeFi) vereint. An der Spitze steht CEO und Mitgründer Dennis Dinkelmeyer, der vor der Gründung im Investment Research bei Branchengrößen wie Goldman Sachs und der Capital Group tätig war. Er bringt das essenzielle Verständnis für die Strukturierung institutioneller Anlageprodukte in die Blockchain-Welt ein.

Ergänzt wird die Führungsriege durch Executive Chairman und Mitgründer Fabrice Grinda. Als Gründungspartner des Investmentfonds FJ Labs gehört Grinda zu den weltweit aktivsten Angel-Investoren. Er steuert neben Kapital und einem enormen Netzwerk auch operative Erfahrung bei, die er unter anderem als Co-Gründer der für über eine Milliarde US-Dollar übernommenen Plattform OLX sammelte. Komplettiert wird das Führungstrio von Mitgründer Romain Bourgois. Der Tech-Experte war fast ein Jahrzehnt in leitenden Produktrollen beim AdTech-Giganten Criteo tätig, bevor er als Head of Product zum US-Konkurrenten Ondo Finance wechselte. Dort leistete er maßgebliche Pionierarbeit bei der Entwicklung und Skalierung der ersten großen tokenisierten US-Staatsanleihen, wie etwa OUSG und USDY.

Fokus auf „Midas Staked Liquidity“ (MSL)

Das frische Kapital soll primär in die Entwicklung und Skalierung der sogenannten Midas Staked Liquidity (MSL) fließen. Dabei handelt es sich um einen dedizierten Liquiditätspuffer, gegen den die firmeneigenen Token (mToken) jederzeit und ohne Wartezeit eingelöst werden können. Für institutionelle Investoren, die Treasury- und Portfolio-Management auf der Blockchain betreiben, ist diese sofortige Liquidität ein entscheidendes Kriterium.

Bisher mussten Rendite-Investoren oft zwischen der sofortigen Handelbarkeit und den Erträgen von DeFi-Protokollen abwägen – MSL soll diesen Kompromiss überflüssig machen. Die Midas-Plattform überführt dafür institutionelle Anlagestrategien, wie etwa Staatsanleihen (mTBILL) oder Basis-Handelsstrategien (mBASIS), in regulierungskonforme Token, die nahtlos in DeFi-Netzwerke wie Morpho oder Pendle integriert werden können. Nach eigenen Angaben hat Midas seit dem Start Token im Gesamtwert von über 1,7 Milliarden US-Dollar emittiert und dabei Erträge in Höhe von 37 Millionen US-Dollar an seine mehr als 20.000 Nutzer ausgeschüttet. Das Fintech finanziert sich dabei über Gebühren, die auf diese erwirtschafteten Renditen erhoben werden.

Die Brücke zwischen Wall Street und Blockchain

„Wir arbeiten auf eine Zukunft hin, in der Investitionen wie das Internet funktionieren: offen, transparent, kombinierbar und standardmäßig zugänglich“, formuliert CEO Dennis Dinkelmeyer den Anspruch des Unternehmens. Vic Singh, General Partner bei RRE Ventures, teilt diese Vision: Die Tokenisierung werde die globalen Kapitalmärkte fundamental verändern, sobald die traditionelle Finanzwelt ihre Infrastruktur vollständig auf die Blockchain verlagere.

Neben der Etablierung von MSL plant Midas, das frische Kapital für die Erschließung weiterer Anlageklassen und den Ausbau von Partnerschaften zu nutzen. Mit dem Einstieg von Schwergewichten wie Franklin Templeton und Coinbase Ventures positioniert sich das 2024 gegründete Unternehmen damit als einer der zentralen Infrastrukturanbieter an der lukrativen Schnittstelle zwischen klassischem Finanzwesen und der Krypto-Ökonomie.

deeplify sammelt 2 Mio. Euro für digitalisierte Inspektionen von Pipelines, Chemieanlagen und Brücken

Das 2023 von Jan Löwer, Christoph Siemer und Felix Asanger gegründete Bochumer Industrial-AI-Start-up deeplify bringt frischen Wind in die analog geprägte und sicherheitskritische Anlagenprüfung.

Die Überwachung von Pipelines, Chemieanlagen und Brücken unterliegt strengsten Sicherheitsvorgaben. Die sogenannte zerstörungsfreie Prüfung (ZfP / NDT) – beispielsweise mittels Ultraschall oder Röntgen – wird traditionell von zertifizierten Prüfer*innen durchgeführt. Die Dokumentation und Auswertung dieser Daten ist in der Regel zeitaufwendig und stark analog geprägt. An dieser Schnittstelle positioniert sich die 2023 gegründete deeplify GmbH aus Bochum. Das Start-up entwickelt KI-Software für sicherheitskritische Inspektionen in Energie, Chemie und Industrie. Die angebotene Software-Plattform soll Aufgabenmanagement, eine KI-gestützte Defektanalyse sowie die Berichtserstellung in einem System bündeln.

Vom Agenturgeschäft zur SaaS-Lösung

Die Idee zu deeplify entstand 2022 aus einer Data-Science-Agentur heraus. Das heutige Führungsteam setzt sich aus drei Personen mit unterschiedlichen fachlichen Schwerpunkten zusammen. CEO Jan Löwer, ein studierter Physiker und vormaliger Gründer besagter Agentur, verantwortet die strategische Ausrichtung des Unternehmens. Die operativen Prozesse steuert Christoph Siemer (COO), der zuvor über zehn Jahre als Manager beim Energiekonzern BP tätig war – eine Branchenerfahrung, die dem Start-up den vertrieblichen Zugang zur Schwerindustrie erleichtern soll. Die technische Entwicklung leitet der Robotik- und Kognitionsexperte Felix Asanger (CTO).

Auf die Frage, woran das anfängliche Agenturmodell im spezifischen Markt gescheitert sei, stellt CEO Jan Löwer klar: „Gescheitert ist das Agenturmodell nicht. Es hat funktioniert und Umsatz gebracht.“ Es sei jedoch auf einen breiteren Markt industrieller Anwendungen ausgelegt gewesen. Den Wechsel zum reinen Software-as-a-Service (SaaS)-Produkt erklärt der Gründer mit dem klaren Blick auf Marktchancen: „Wir haben dabei gesehen, dass im SaaS-Produkt das deutlich größere Skalierungspotenzial liegt.“ Der Pivot sei eine bewusste strategische Entscheidung gewesen, fügt Löwer hinzu: „Wir haben uns gefragt, wo wir den größten Hebel haben und die Antwort war eindeutig.“

Plattformansatz für Inspektionsdaten

Mit dem Produkt „deeplify inspect“ verfolgt das Unternehmen das Ziel, die oft fragmentierten Prüfdaten verschiedener Hardware-Hersteller*innen in einer DICONDE-kompatiblen Datenbank zu zentralisieren. Darauf aufbauend sollen KI-Algorithmen die Inspektor*innen bei der Fehlererkennung unterstützen. Das SaaS-Modell verspricht eine Standardisierung der Qualitätssicherung sowie eine Reduktion der Auswertungskosten. Laut Unternehmensangaben konnte deeplify bereits erste Kund*innen im Energiesektor gewinnen. Dazu zählt unter anderem der Fernleitungsnetzbetreiber Open Grid Europe (OGE), mit dem im Zuge von Transformationsprojekten Datensätze zusammengeführt wurden. Zudem gibt es Kooperationen mit Inspektionsunternehmen.

Die Schwerindustrie gilt als konservativ, und Hardware-Hersteller setzen oft auf eigene Software-Silos. Löwer sieht darin jedoch keine unüberwindbare Hürde: „Vendor-Lock-ins sind in der Anlagenprüfung weniger ausgeprägt. Betreiber setzen mehrere Hardware-Lösungen parallel ein und legen Wert auf Unabhängigkeit.“ Deeplify positioniere sich exakt an diesem Punkt: „Als herstellerunabhängige Plattform integrieren wir Inspektionsdaten aus bestehenden Systemen über standardisierte Schnittstellen und überführen sie in ein offenes Format“, betont der Gründer.

Das Versprechen an die Industrie formuliert er deutlich: „Die Unternehmen behalten ihre Hardware, wir schaffen auf der Datenebene zentrale Verfügbarkeit, Vergleichbarkeit und KI-gestützte Auswertung.“ Um die Lösung auch für Konzerne wie OGE wirtschaftlich attraktiv zu machen, verzichtet deeplify beim Pricing bewusst auf große Upfront-Investments. Löwer skizziert das Modell: „Unternehmen starten mit einer Testphase und geringen Einstiegshürden, der Funktionsumfang skaliert modular mit dem tatsächlichen Bedarf.“

Marktumfeld & regulatorische Barrieren

Der Markt für Asset-Integrity-Management wächst, bedingt durch eine alternde europäische Infrastruktur und einen zunehmenden Mangel an qualifiziertem Prüfpersonal. Gleichzeitig sind die Markteintrittsbarrieren extrem hoch. In sicherheitskritischen Bereichen gelten strenge Zertifizierungsvorgaben, und die Haftungsrisiken bei übersehenen Defekten sind immens.

Um die regulatorischen Hürden zu umgehen, positioniert deeplify seine KI nicht als autonomen Prüfer, sondern wählt einen „Human-in-the-loop“-Ansatz. Die Software assistiert, die finale rechtliche Verantwortung und Entscheidungsgewalt verbleibt bei den menschlichen Prüferinnen. Auf das Risiko angesprochen, dass Prüferinnen sich zunehmend blind auf die KI verlassen könnten (Automation Bias), kontert Löwer: „Unser Ziel ist nicht, den Prüfer zu ersetzen, sondern seine Entscheidungsqualität messbar zu stärken.“ Er bezeichnet den Human-in-the-loop-Ansatz als „bewusstes Designprinzip“. Die KI sei primär als Assistenzsystem konzipiert: „Sie macht Vorschläge transparent, weist Unsicherheiten aus und liefert nachvollziehbare Entscheidungsgrundlagen“, so der CEO. Er versichert zudem, dass bestehende Prüfprozesse, Normen und Vier-Augen-Prinzipien vollständig erhalten blieben.

Auch das Training der KI-Modelle erfordert den Zugang zu hochspezifischen, oft vertraulichen Datensätzen der Anlagenbetreiber*innen. Löwer erklärt die Beschaffung dieser sensiblen Daten: „Beim Thema Trainingsdaten setzen wir auf enge Partnerschaften mit Anlagenbetreibern, die uns bereits für Entwicklung und Validierung reale Prüfdaten zur Verfügung stellen.“ Das ermögliche praxisnahes Training und stelle sicher, „dass unsere Modelle unter realen Bedingungen zuverlässig arbeiten“.

Der technologische Burggraben im starken Wettbewerb

Der NDT-Softwaremarkt ist stark fragmentiert und zunehmend umkämpft. Auf der einen Seite stehen internationale Start-ups und Scale-ups wie HUVRdata oder Abyss Solutions sowie Tech-Spezialisten wie Screening Eagle. Auf der anderen Seite rüsten etablierte NDT-Riesen wie Waygate Technologies ihre Systeme mit KI-Komponenten aus, während Prüfkonzerne wie TÜV oder SGS signifikant in Digitalisierungseinheiten investieren.

Deeplify muss beweisen, dass der herstellerunabhängige SaaS-Ansatz diesen teils proprietären Systemen überlegen ist. Globale Konzerne und Hardware-Marktführer sitzen auf riesigen historischen Datenbergen. Auf die Frage nach dem tatsächlichen technologischen Burggraben (Moat) gegenüber etablierten Playern stellt Löwer einen grundlegenden Besitzanspruch klar: „Der entscheidende Punkt ist: Die Daten gehören den Anlagenbetreibern, nicht den Hardware-Herstellern“. Deeplify positioniere sich als herstellerunabhängige Daten- und KI-Schicht, „die systemübergreifend integriert und erstmals echte Interoperabilität in der Anlagenprüfung schafft“.

Den eigenen Wettbewerbsvorteil definiert Löwer sehr spezifisch: „Unser Moat liegt in der Kombination aus tiefem NDT- und Asset-Integrity-Know-how mit spezialisierten, proprietären KI-Modellen, die direkt auf Rohdatenebene arbeiten.“ Der Gründer übt in diesem Zusammenhang auch Kritik am Status quo der Branche: „Viele etablierte Anbieter sind in ihren eigenen Ökosystemen gefangen und können diese Perspektive kaum abbilden.“ Durch Projekte und Partnerschaften baue deeplify kontinuierlich einen praxisnahen Datenkontext auf, „der nicht als Silo funktioniert, sondern als lernende, interoperable Plattform wächst“, schließt Löwer.

Finanzierung & Ausblick

Zur Finanzierung des weiteren Wachstums schließt deeplify nun offiziell eine Pre-Seed-Runde über 2 Mio. Euro ab. Lead-Investor ist D11Z Ventures. Außerdem beteiligen sich Vanagon Ventures, EWOR und strategische Business Angels. Mit dem frischen Kapital will deeplify die technische Infrastruktur der Plattform ausbauen und weitere Einführungen bei Kund*innen in Europa beschleunigen.

Trotz der Wurzeln im Ruhrgebiet sucht das Start-up für die Entwicklung von sogenannter Agentic AI laut öffentlichen Hiring-Daten nun Personal am Standort München. Löwer begründet diese Entscheidung mit den ambitionierten Zielen des Unternehmens: „Deeplify ist auf einem Wachstumskurs. Wir benötigen die besten Talente für unser Team.“ Die Wahl des neuen Standorts sei folgerichtig: „München ist eine bewusste strategische Entscheidung. Die Stadt bietet Zugang zu einem der stärksten KI-Talentpools in Europa, ein dichtes Ökosystem aus DeepTech-Unternehmen und Forschungseinrichtungen sowie die Nähe zu potenziellen Industriekunden."

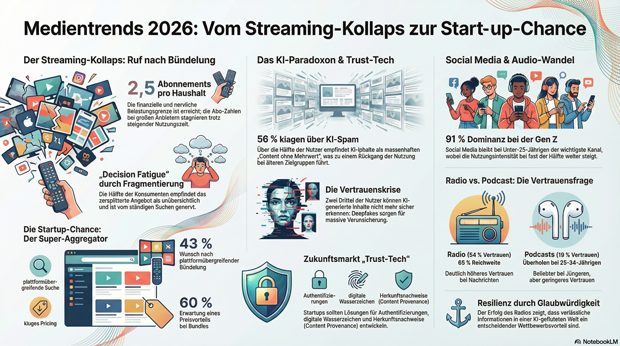

Mediennutzung 2026: Zwischen KI-Frust, Abo-Müdigkeit und neuen Chancen für Start-ups

Die Deutschen experimentieren so intensiv wie nie mit künstlicher Intelligenz (KI), sind aber zunehmend genervt von Deepfakes und „Content ohne Mehrwert“. Gleichzeitig sehnt sich der überhitzte Streaming-Markt nach einer drastischen Konsolidierung. Die aktuelle Deloitte-Studie „Media Consumer Trends 2026“ liefert nicht nur Bestandsaufnahmen, sondern zeigt deutlich, wo für Gründer*innen und Tech-Unternehmen jetzt die wahren Opportunitäten liegen.

Social Media bleibt der unangefochtene Platzhirsch der Medienlandschaft: 78 Prozent der Konsument*innen in Deutschland sind auf den Plattformen aktiv, bei der Gen Z (unter 25 Jahre) sind es sogar satte 91 Prozent. Fast die Hälfte dieser jungen Zielgruppe nutzt Instagram, TikTok und Co. heute intensiver als noch im Vorjahr. Doch ein Blick unter die Oberfläche offenbart Risse im digitalen Fundament – und die haben maßgeblich mit dem rasanten Einzug generativer künstlicher Intelligenz (KI) zu tun.

Das KI-Paradoxon: Große Kreationslust, massives Vertrauensproblem

Auf der Creator-Seite ist KI bereits Alltag. 22 Prozent der Befragten haben laut Deloitte schon Bilder per KI erstellt, jeder Zehnte generiert Videos oder Musik. Auch die Zahlungsbereitschaft ist überraschend hoch: Jeder Fünfte wäre bereit, monatlich über 10 Euro für entsprechende Tools auszugeben.

Auf der Konsument*innenseite jedoch kippt die Stimmung bedenklich. Zwei Drittel der Nutzer*innen geben an, dass sie KI-generierte Inhalte im Netz nicht mehr zuverlässig erkennen können. Schlimmer noch: 56 Prozent klagen über eine wachsende Flut an KI-generierten Postings „ohne Mehrwert“ – schlichtweg digitaler Spam. Die Konsequenz dieser Verunsicherung zeigt sich bereits in den Nutzungsdaten: Erste Altersgruppen, insbesondere Nutzer*innen ab Mitte 50, beginnen, ihren Social-Media-Konsum aktiv zurückzufahren.

Die Start-up-Perspektive: Die Zeiten des blinden KI-Hypes sind vorbei. Wer als Gründer*in heute rein quantitativ auf automatisierte Content-Erstellung setzt, riskiert Reichweite und Glaubwürdigkeit. Wie Deloitte-Expertin Sophie Pastowski anmerkt, braucht es dringend „transparente Kennzeichnung, um Vertrauen im digitalen Raum zu stärken.“ Genau hier entsteht ein massiver Zukunftsmarkt für „Trust-Tech“-Start-ups: Werkzeuge, die Authentizität verifizieren, Deepfakes zuverlässig herausfiltern, digitale Wasserzeichen etablieren oder Content-Provenance (Herkunftsnachweise) sichern, werden zu kritischen Erfolgsfaktoren für Plattformen und Verlage.

Streaming-Kollaps: Die Sehnsucht nach dem Super-Aggregator