Aktuelle Events

Vom Labor zur Großindustrie: MicroHarvest startet Bau einer 15.000-Tonnen-Anlage

12.02.2026

Das 2021 von Katelijne Bekers, Jonathan Roberz und Dr. Luísa Cruz gegründete Hamburger BioTech MicroHarvest vollzieht den Schritt vom Labor in die industrielle Massenproduktion. Im Chemiepark Leuna entsteht eine kommerzielle Großanlage mit einer Jahreskapazität von 15.000 Tonnen.

Der Hamburger Proteinhersteller MicroHarvest verlässt den Pilotmaßstab und beginnt mit der industriellen Umsetzung seiner Fermentationstechnologie. Wie das Unternehmen am 12. Februar bekannt gab, fiel die Standortwahl für die erste kommerzielle Großanlage auf den Chemiepark Leuna in Sachsen-Anhalt.

Rapider Aufstieg: Von der Gründung zum Anlagenbau

Das Tempo, das MicroHarvest vorlegt, ist im Deep-Tech-Bereich ungewöhnlich hoch. Gegründet 2021 von Katelijne Bekers (CEO), Jonathan Roberz (COO) und Dr. Luísa Cruz (CTO) in Hamburg, gelang dem Gründer-Trio binnen weniger Jahre gelang der Sprung von der Verfahrensentwicklung zur Planung einer Großanlage, deren Produktionsstart bereits in rund zwei Jahren vorgesehen ist.

Technologie: Biomasse-Fermentation in Rekordzeit

Kern des Erfolgs ist ein proprietäres Verfahren der Biomasse-Fermentation. Anders als bei der Präzisionsfermentation werden hier die Mikroorganismen selbst zum Produkt: Bakterien vermehren sich exponentiell und werden zu sogenanntem Single Cell Protein (SCP) verarbeitet. Der technologische USP liegt in der Geschwindigkeit: Vom Rohstoff bis zum fertigen Protein vergehen laut MicroHarvest nur 24 Stunden. Das Verfahren gilt als eines der effizientesten weltweit und benötigt nur einen Bruchteil der Fläche und des Wassers konventioneller Proteinquellen.

Validierung durch Top-Investoren und Awards

Dass das Scale-up nun eine Investition im mittleren zweistelligen Millionenbereich stemmen kann, ist auch das Resultat einer soliden Finanzierungsstrategie. Bereits 2022 sicherte sich MicroHarvest in einer Series-A-Runde Kapital, angeführt von FoodTech-VCs wie Astanor Ventures und FoodLabs. Für den Bau in Leuna kommt nun ein Zuwendungsbescheid über knapp 5,5 Millionen Euro aus der Bundesförderung für Energie- und Ressourceneffizienz hinzu.

Standortentscheidung und Marktstrategie

In Leuna sollen rund 25 direkte Arbeitsplätze entstehen. Die Entscheidung für den Standort fiel nach der Prüfung von rund 40 Optionen in Europa. Ausschlaggebend waren die industrielle Infrastruktur und die Nähe zu regionalen Rohstoffen wie Melasse, die kurze Transportwege ermöglichen.

„Wir bauen kein Pilotprojekt, sondern eine Produktionsinfrastruktur für relevante Mengen. Leuna bietet dafür genau das richtige Umfeld: bestehende Industrie, verlässliche Utilities und ein regionales Agrar- und Verarbeitungsnetzwerk“, betont Co-Founder Jonathan Roberz.

Marktseitig ist der Boden bereitet: MicroHarvest zielt zunächst auf den B2B-Markt für Tiernahrung und Aquakultur und konnte bereits Produkteinführungen mit Partnern wie VEGDOG und THE PACK realisieren. Perspektivisch arbeitet das Unternehmen auch an Anwendungen für den Human-Food-Bereich.

Learnings für Gründer*innen

Der Case MicroHarvest zeigt exemplarisch, dass für Hardware-Start-ups die Standortwahl keine reine Immobilienthematik ist. Die Anbindung an bestehende Ökosysteme – hier die Stoffströme und Utilities eines etablierten Chemieparks – kann den entscheidenden Geschwindigkeitsvorteil beim Roll-out liefern. Zudem beweist die Finanzierungsstruktur, wie wichtig der intelligente Mix aus Venture Capital und staatlicher Förderung (hier für Capex) ist, um kapitalintensive Industrieprojekte zu realisieren.

Diese Artikel könnten Sie auch interessieren:

Produktivität statt Überstunden: Wie Echtzeitdaten das Finanzwesen von morgen steuern

Das KI-gestützte Fintech Embat beendet das Excel-Chaos im Treasury und macht Finanzteams mit Echtzeitdaten fit für die Zukunft.

Berlin, 28. April 2026 – Es ist ein bekanntes Bild in den Finanz- und Treasury-Abteilungen des deutschen Mittelstands: Wenn der Monatsabschluss naht oder Ad-hoc-Berichte für die Geschäftsführung benötigt werden, bleiben die Schreibtischlampen bis spät in die Nacht an. Die manuelle Zusammenführung von Daten aus unterschiedlichen Bankportalen und historisch gewachsenen Excel-Listen kostet nicht nur Nerven, sondern vor allem wertvolle Zeit.

Das schnell wachsende Fintech Embat tritt an, um genau diesen Engpass aufzulösen. André Reimers, Head of DACH, treibt diese Mission im deutschsprachigen Raum als Gesicht des Unternehmens voran. Seine Kernüberzeugung: Wer heute noch regelmäßig Überstunden machen muss, um finanzielle Transparenz zu schaffen, leidet nicht unter mangelnder Einsatzbereitschaft – er leidet unter einem strukturellen Datenproblem.

Beeindruckendes Wachstum durch das Lösen echter Pain Points

Dass der Schmerz in den Finanzabteilungen groß und der Bedarf an modernen Lösungen riesig ist, belegen die Zahlen, mit denen Embat den europäischen Markt aufrollt. Mit einem starken Kundenwachstum im deutschen Markt von über 250 Prozent im vergangenen Jahr und mittlerweile mehr als 400 mittelständischen und großen Unternehmenskunden weltweit hat sich das Fintech als fester Player etabliert. Das stetig wachsende Transaktionsvolumen von 250 Millionen Euro zeigt deutlich: Der Wechsel von fehleranfälligen Tabellen zu automatisierten Cloud-Lösungen ist in vollem Gange.

Der Weg aus der Excel-Falle

Mit seiner Technologie nimmt Embat den Kampf gegen ineffiziente Prozesse im Treasury auf. Anstatt hochqualifizierte Mitarbeiter mit repetitiver Datenpflege zu binden, automatisiert das System die Konsolidierung aller relevanten Finanzdaten.

„Die Erwartungshaltung, dass komplexe Finanzanalysen zwingend mit langen Abenden im Büro einhergehen müssen, ist schlichtweg nicht mehr zeitgemäß“, erklärt André Reimers. „Wenn Cashflow, Liquidität und Runways per Knopfdruck in Echtzeit abrufbar sind, ändert sich die gesamte Arbeitsdynamik. Finanzteams können aus dem reaktiven Modus heraustreten und sich auf die strategische Steuerung des Unternehmens konzentrieren.“

Hohe Innovationskraft trifft auf lokales DACH-Verständnis

Embat profitiert von einer enormen Innovationsgeschwindigkeit und Agilität, auf der die starke technologische Basis des Unternehmens beruht. Wie diese passgenau auf die spezifischen Bedürfnisse des deutschen Marktes übersetzt wird und für eine hohe lokale Marktpräsenz sorgt, zeigt André Reimers an den Standorten in München und Berlin.

Von diesen beiden Standorten aus steuert André Reimers das DACH-Geschäft und stellt das tiefe Verständnis für die komplexen Strukturen und hohen Sicherheitsbedürfnisse des deutschen Mittelstands sicher. Das Team zeigt dabei, wie moderne, dezentrale Zusammenarbeit erfolgreich funktioniert. Das Vertrauen der stetig wachsenden deutschen Kundenbasis fußt dabei auf dieser geballten lokalen Expertise gepaart mit der unerschütterlichen Zuverlässigkeit der Systeme.

Führen durch Resultate, nicht durch Anwesenheit

Die Botschaft an die Finanzwelt ist klar: Moderne Führung, hohe Produktivität und Skalierbarkeit erfordern keine starren Kontrollmechanismen oder endlosen Arbeitstage. Sie erfordern radikale Datentransparenz und die richtigen digitalen Werkzeuge. Wenn die Daten in Echtzeit fließen, sinkt die Fehlerquote, die Entscheidungsgeschwindigkeit steigt – und die systembedingten Überstunden im Treasury gehören endgültig der Vergangenheit an.

Über Embat:

Embat ist ein KI-gestütztes FinTech mit Schwerpunkt auf Treasury-Management, das es mittelständischen Unternehmen und Großkonzernen ermöglicht, ihre Finanzprozesse in Echtzeit zu zentralisieren. Gegründet von Antonio Berga und Carlos Serrano – ehemaligen J.P. Morgan-Managern mit umfassender Erfahrung im Corporate Banking – sowie Tomás Gil, dem ehemaligen CTO von Fintonic, entstand die Plattform mit der Mission, die Finanzabteilung zu digitalisieren. Die klare Prämisse dabei: Technologie von Finanzexperten für Finanzexperten.

Durch seine hybride Konnektivität lässt sich Embat in über 15.000 Banken und führende ERP-Systeme integrieren und beseitigt so jegliche Datenfragmentierung. Das wichtigste Alleinstellungsmerkmal ist TellMe, ein „Agentic Treasury Analyst“ (autonomer KI-Analyst), der Cashflow-Muster erkennt, komplexe Kontenabstimmungen automatisiert und strategische Entscheidungen zur Optimierung der Liquidität vorschlägt.

Mit Niederlassungen in Madrid, London, Berlin und München definiert Embat die Zukunft des Corporate Finance neu.

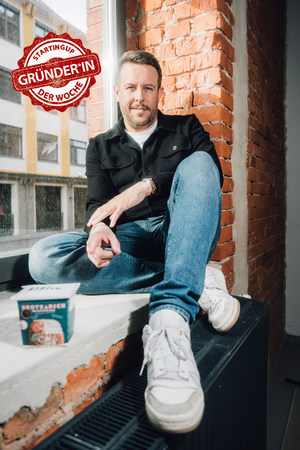

Gründer*in der Woche: Brotrausch – Premium-Teig im recycelten Messbecher

Backen ohne Frust: Wie Brotrausch mit smarten Premium-Mischungen im recycelbaren Messbecher den hart umkämpften DIY-Brotmarkt aufmischen will.

Hinter der 2022 ins Leben gerufenen Marke Brotrausch, die 2023 offiziell an den Start ging, steht heute die Bremer Brot GmbH. Das Unternehmen hat die Marke im Jahr 2025 durch einen Asset Deal übernommen. An der Spitze des Start-ups steht ein Gründer, dessen Wurzeln weit abseits des klassischen Bäckerhandwerks liegen. Philipp Herrnberger, einst in der Sportvermarktung bei Werder Bremen tätig, gründete nicht aus einer entspannten Laune heraus, sondern aus gesundheitlichen Gründen. Nach dem Konsum von herkömmlichem Industrie-Brot kämpfte er immer wieder mit Beschwerden. Sein Antrieb: Ein bekömmliches, transparentes Brot ohne Zusatzstoffe zu kreieren, das man ohne Vorwissen einfach selbst backen kann.

Der Sprung aus der Agenturwelt in die Food-Szene war unkonventionell, doch genau das habe dem Team geholfen, „Dinge anders zu denken“, erinnert sich Herrnberger. In der ersten Phase finanzierte sich das anfänglich fünfköpfige Gesellschafterteam komplett aus eigenen Mitteln. Der Mix aus Bäckermeister, Kaufmann und Kreativen brachte dabei entscheidende Vorteile: „Wir konnten uns voll auf Produkt und Marke konzentrieren, ohne von Anfang an von externen Erwartungen getrieben zu sein“, erklärt der Geschäftsführer. Dennoch räumt er rückblickend offen ein, dass der Bootstrapping-Ansatz an seine Grenzen stieß. „Unter dem Strich muss man sagen, dass wir es ohne externe Investoren nicht geschafft haben“, resümiert Herrnberger über den rettenden Asset-Deal und Neustart im Sommer 2025.

Premium-Teig im recycelten Messbecher

Das Geschäftsmodell hebt sich bewusst vom preissensiblen Massenmarkt ab und richtet sich an all jene, denen im Post-Corona-Alltag schlichtweg die Zeit für aufwändige Sauerteig-Experimente fehlt. Hier setzt das Start-up mit absoluter Convenience an: Die neun natürlichen Brotmischungen erfordern laut Hersteller keinerlei Backerfahrung, kommen gänzlich ohne Küchenmaschine aus und beschränken sich auf rund zehn Minuten aktive Arbeitszeit. Die Zutaten für die „Made in Germany“-Strategie stammen aus kontrolliertem, regionalem Anbau.

Raffiniert und praktisch zugleich ist die Verpackungslösung: Die Mischungen ruhen in einem PET-Becher, der direkt als exakter Messbecher für die benötigte Wasserzugabe dient. Doch gerade ein Plastikbecher weckt in der nachhaltigkeitsgetriebenen Zielgruppe oft Skepsis. Herrnberger verteidigt die Entscheidung leidenschaftlich und verweist auf das rigorose Ausschlussverfahren in der Produktentwicklung. „Kraftpapiertüten sehen offensichtlich nachhaltig aus, wenn sie aber wie für uns beschichtet wären, können sie nur noch verbrannt werden“, kontert der Gründer. Dies sei überhaupt nicht im Sinne der Ressourcenschonung. Stattdessen setzt Brotrausch auf einen vollständig aus recyceltem PET bestehenden Becher einer deutschen Firma. Da die Pappbanderole raffiniert „einschnappt“ und nicht geklebt wird, seien beide Komponenten zu 100 Prozent wiederrecycelbar. Damit sei die Marke auch fit für zukünftige rechtliche Verpackungsvorschriften.

Smarte Nischen und margenstarkes Upselling

Anstatt den oft verlustreichen Preiskampf im regulären Supermarktregal zu suchen, etabliert sich Brotrausch konsequent als D2C-Marke im Premium-Segment. Eine reguläre Brotbackmischung schlägt mit 5,99 Euro zu Buche – eine echte Ansage für ein Produkt, in das die Kundschaft noch Strom, Wasser und Arbeitszeit investieren muss.

„Auf den ersten Blick wirkt der Preis natürlich hoch, vor allem, wenn man ihn rein mit Mehl vergleicht“, gibt Herrnberger zu bedenken. Dieser Vergleich greife jedoch zu kurz. „Wir verkaufen kein Rohprodukt, sondern ein durchdachtes Gesamterlebnis“, betont er und verweist auf die raffinierten Rezepturen und Prozesse, die zu einem Resultat führen, „das viele so zuhause sonst nicht hinbekommen würden“. Die Preisakzeptanz misst das Unternehmen primär über das Feedback und das Kaufverhalten. Als Kund*innen begannen, nicht nur ein zweites Mal zu bestellen, sondern direkt größere Pakete und mehrere Sorten in den Warenkorb legten, wusste das Team: Der Markt akzeptiert den Premium-Aufschlag. Zudem stellt Herrnberger klar: „Im Übrigen kostet das Backen im heimischen und relativ neuen Backofen keine 25 Cent.“

Aus den regulären Supermärkten hat sich Brotrausch mittlerweile bewusst zurückgezogen, da der Kampf um die Regale dort stark über den Preis diktiert wird. „Wir fokussieren uns nun auf Genusspartner wie Weinhändler, Hofläden oder Feinkosthändler, bei denen die Preise hochwertiger Produkte eher akzeptiert werden“, erklärt der Geschäftsführer den strategischen Kurswechsel.

Um die ambitionierte Preisgestaltung zu rechtfertigen, inszeniert das Start-up seine Produkte gezielt als Lifestyle-Upgrade – etwa für das autarke Vanlife beim Camping, als Mitbringsel zum Grillen oder für den Osterbrunch. Flankiert wird das Kernsortiment durch ein lukratives Upselling-Portfolio, das von stilvollen Geschenkboxen für knapp 30 Euro bis hin zu speziellen Baguette-Backblechen, Fruchtaufstrichen und Stullensalzen reicht. Diese Zusatzartikel seien laut Herrnberger zwar nicht essenziell für das Überleben des Unternehmens, da das Brotbacken der Mittelpunkt bleibe, sie seien aber entscheidend für das Wachstum. „Im E-Commerce geht es um den durchschnittlichen Warenkorb und die Retention“, analysiert der Gründer. Das Zusatzsortiment mache das „Erlebnis Brot“ noch intensiver. Der Umsatzanteil dieser lukrativen Extras liegt aktuell bei knapp 15 Prozent.

Die Gretchenfrage der Kund*innenbindung

Dieser strategische Ansatz sichert gesunde Margen und entzieht die Marke geschickt der Vergleichbarkeit mit Discountern. Dennoch bleibt eine große Herausforderung: Der Markt für DIY-Lebensmittel ist durch starke Bio-Traditionsmarken massiv umkämpft. Die größte Hürde besteht darin, die Wiederkaufsrate auf einem profitablen Niveau zu halten. Denn wenn die stylische Mischung primär als originelles Präsent zum Vatertag verschenkt wird, fehlen dem Unternehmen am Ende die wiederkehrenden Alltagsumsätze.

Einen aggressiven Rollout in den stationären Einzelhandel schließt Herrnberger vorerst aus. Dies sei nur mit hohen Investitionen machbar und berge das Risiko, zu einem „One-Hit-Wonder“ zu verkommen. Die Devise lautet stattdessen: „Wir wollen gesund wachsen, um profitabel zu werden.“ Die Geschenkboxen spielen in dieser Strategie eine überraschende Doppelrolle. Sie treffen nicht nur den Zeitgeist, sondern fungieren als cleverer Akquise-Kanal. „Wir erreichen dadurch Menschen, die uns vielleicht noch nicht kennen und unmittelbar mit der Marke, der Qualität und dem Erlebnis in Berührung kommen“, freut sich Herrnberger. Auf diese Weise spare man sich enorme Kund*innenakquisitionskosten. Zudem entwickle sich das Geschenke-Segment zunehmend zu einem echten Profitcenter im B2B-Bereich – etwa wenn Immobilienmakler die Boxen zur Hausübergabe als modernes „Brot und Salz“-Präsent nutzen.

Trotz der starken Nischen-Performance ist klar: Brotrausch muss langfristig beweisen, dass das Premium-Brot aus dem Becher nicht nur an Feiertagen verschenkt wird, sondern den dauerhaften Sprung in die alltägliche Frühstücksroutine der Konsument*innen schafft.

Primogene: 4,1 Mio. Euro für den Muttermilch-Code – Deep-Tech-Innovation oder riskantes Unterfangen?

Das Leipziger BioTech-Start-up Primogene hat eine Seed-Finanzierung in Höhe von 4,1 Mio. Euro eingesammelt, um komplexe bioaktive Moleküle im industriellen Maßstab auf den Markt zu bringen.

Während die Unternehmenskommunikation den Durchbruch einer neuen Plattformtechnologie feiert, zeigt ein genauerer Blick auf den globalen Markt für humane Milcholigosaccharide (HMOs) ein Haifischbecken voller multinationaler Konzerne. Eine kritische Analyse des Geschäftsmodells, der Gründer*innen und des Wettbewerbs.

DeepTech Made in Leipzig

Hinter Primogene stehen Dr.-Ing. Reza Mahour (CEO), Valerian Grote und Linda Karger (COO), die das Unternehmen 2023 in Leipzig gründeten. Die Zusammensetzung des Teams vereint technologische und wissenschaftliche Expertise, um die ehrgeizige Vision einer industriellen Enzym-Produktion umzusetzen. Die aktuelle, 4,1 Millionen Euro starke Seed-Runde wird vom High-Tech Gründerfonds (HTGF) angeführt. Zum Investoren-Konsortium gehören außerdem der Technologiegründerfonds Sachsen (TGFS), better ventures, die Sächsische Beteiligungsgesellschaft (SBG), die Golzern Holding GmbH, die FS Life Science Investment GmbH sowie Dr. Marc Struhalla, Gründer und CEO der c-LEcta GmbH. Der Kapitaleinsatz ist klar definiert: Die neuen Mittel fließen in den Ausbau des IP-Portfolios, die Erweiterung der Produktionskapazitäten in Leipzig und in strategische Partnerschaften.

Das Modell im Stresstest: Die Kostenfalle der Enzyme

Primogene hat eine enzymatische Plattformtechnologie entwickelt, um Inhaltsstoffe zu produzieren, die identisch zu natürlichen Molekülen sind – nachhaltig und kosteneffizient. Im Zentrum stehen dabei komplexe humane Milcholigosaccharide (HMOs) wie Disialyllacto-N-Tetraose (DSLNT) und Difucosyllacto-N-Tetraose I (LNDFH I). Laut Primogene verursachen etablierte fermentative Herstellungsverfahren erhebliche Kosten und stoßen bei der Produktion derartiger hochkomplexer Moleküle an ihre Grenzen.

Der Lackmustest: Die Prämisse, dass enzymatische Verfahren in der Massenproduktion überlegen sind, birgt in der Praxis massive Hürden. Die Entwicklung und wirtschaftliche Produktion der benötigten Enzyme selbst ist extrem kapitalintensiv. Dass das Start-up den gesamten Prozess – von der Enzymentwicklung über die Produktion und Biotransformation bis zur Aufreinigung – komplett am eigenen Unternehmensstandort in Leipzig abbilden will, ist ein ambitionierter, aber riskanter Schritt. Der Aufbau eigener Produktionsanlagen für komplexe BioTech-Prozesse führt oft zu einer enorm hohen Kapitalverbrennungsrate (Burn Rate).

Erste kommerzielle Meilensteine dämpfen dieses Risiko jedoch: Erste Inhaltsstoffe für Kosmetikprodukte wurden mit Kooperationspartnern entwickelt und sind bereits kommerziell erhältlich. Auch pharmazeutische Rohstoffe befinden sich aktuell im Test bei Kund*innen. Zudem erforscht das Unternehmen in Zusammenarbeit mit dem Fraunhofer-Institut für Zelltherapie und Immunologie (IZI) in Leipzig das Potenzial seiner Inhaltsstoffe zur Prävention von Infektionskrankheiten.

Im Haifischbecken: Auf Kollisionskurs mit den Lebensmittel-Riesen

Der Zielmarkt ist hochattraktiv: Der globale HMO-Markt wächst jährlich um etwa 18 bis 20 Prozent, und über 65 Prozent der im Jahr 2023 neu eingeführten Säuglingsnahrungsprodukte enthielten mindestens ein HMO. Neben der Säuglingsernährung bedient Primogene auch Märkte wie die Darmgesundheit bei Erwachsenen, die Gedächtnisverbesserung im Alter sowie funktionale Inhaltsstoffe für Körperpflege und pharmazeutische Rohstoffe.

Das Leipziger Team trifft in der Nahrungsmittelindustrie jedoch auf einen extrem konsolidierten Markt, der von Milliarden-Konzernen dominiert wird. Einer der größten B2B-Zulieferer für Säuglingsnahrung weltweit ist DSM-Firmenich (mit der übernommenen Sparte Glycom), der den Markt durch gigantische Größenvorteile (Economies of Scale) in der Fermentation beherrscht. Auch Chr. Hansen (Jennewein), ein Pionier in der mikrobiellen HMO-Synthese, stellt mit seiner extrem tiefen Integration bei Lebensmittelriesen einen massiven Konkurrenten dar. Auf der Abnehmerseite agieren Endkonsument*innen-Giganten und Branchenführer wie Nestlé und Abbott, bei denen für einen neuen Zulieferer von Inhaltsstoffen extrem hohe regulatorische und volumenbasierte Hürden bestehen.

Primogenes strategische Nische: Ein Preiskampf bei einfach strukturierten Standard-HMOs gegen die großen Fermentations-Player wäre für ein Start-up kaum zu gewinnen. Primogenes entscheidender Wettbewerbsvorteil liegt jedoch in der Komplexität. Die industrielle Produktion von Molekülen wie DSLNT – das laut klinischen Studien signifikante gesundheitliche Vorteile speziell für Frühgeborene bietet – war bislang schlicht nicht möglich. Wenn Primogene hier durch sein starkes Patentportfolio die technologische Lücke schließt, umgeht das Unternehmen den harten Konkurrenzkampf im Massenmarkt.

Unser Fazit: Hohes Risiko, riesiger Hebel

Primogene ist kein schlankes Software-Projekt, sondern waschechtes DeepTech. Das bedeutet: Hohe regulatorische Hürden, langer Atem in der Forschung und massive Kapitalanforderungen. Die Seed-Finanzierung in Höhe von 4,1 Millionen Euro ist ein starker Vertrauensbeweis erfahrener Investoren, wird für den Anlagenbau und die Skalierung der Leipziger Produktion auf Dauer jedoch kaum ausreichen. Primogene muss nun rasch beweisen, dass die enzymatische Synthese nicht nur technologisch überlegen, sondern auch unter realen industriellen Kostendrücken skalierbar ist. Gelingt dieser Proof of Concept, hält das Start-up den Schlüssel zu einer neuen Generation komplexer, bioaktiver Moleküle in der Hand.

Wie das TechBio-Start-up mbiomics mit 30 Mio. Euro die Krebstherapie skalierbar machen will

Stuhltransplantationen haben gezeigt, dass das Darmmikrobiom ein mächtiger Hebel gegen Krebs sein kann – doch der Ansatz ist bisher kaum standardisierbar. Das Münchner Unternehmen mbiomics setzt auf künstliche Intelligenz und maßgeschneiderte Bakterien-Cocktails aus dem Labor. Mit dem Abschluss einer 30-Millionen-Euro-Serie-A-Runde rückt die klinische Phase näher. Ein genauer Blick auf das Geschäftsmodell, die Gründer*innen und einen hart umkämpften globalen Markt.

Wer heute von modernster Krebstherapie spricht, kommt am menschlichen Darm nicht mehr vorbei. Die wissenschaftliche Datenlage der letzten Jahre hat sich massiv verdichtet: Ob ein Patient auf revolutionäre Krebs-Immuntherapien (wie Immun-Checkpoint-Inhibitoren) anspricht, hängt maßgeblich von der individuellen Zusammensetzung seines Mikrobioms ab. Das Münchner TechBio-Unternehmen mbiomics hat sich genau dieses Zusammenspiel zur Mission gemacht und gab heute den dritten Abschluss seiner Serie-A-Finanzierungsrunde bekannt. Mit neu eingeworbenen 12 Millionen Euro wächst das Gesamtvolumen der Runde auf beachtliche 30 Millionen Euro.

Das Kapital, das unter anderem von erfahrenen Investoren wie den MIG Fonds und Bayern Kapital stammt, markiert für das 2020 gegründete Unternehmen einen entscheidenden Wendepunkt: den Übergang von der reinen Technologieplattform hin zur klinischen Anwendung am Menschen. Der führende Wirkstoffkandidat „MBX-116“ soll 2027 in einer Phase-1B-Studie an Patienten mit fortgeschrittenem schwarzen Hautkrebs (Melanom) getestet werden. Doch wie belastbar ist dieser Ansatz im Vergleich zum Wettbewerb?

Die Köpfe hinter der Vision

Aus der Taufe gehoben wurde mbiomics im Jahr 2020 von Dr. Laura Figulla, Dr. Johannes B. Wöhrstein und Dr. Markus Rinecker. Während die Mitgründer Figulla und Rinecker das Unternehmen in der frühen Phase prägten, wird die nun anstehende Skalierung und klinische Validierung von einem spezialisierten Leadership-Trio gesteuert:

- Dr. Johannes B. Wöhrstein (CEO & Mitgründer): Als technologischer Kopf und Geschäftsführer verantwortet er die firmeneigene Plattform. Seine Expertise in hochauflösender Analytik ist das Fundament, um komplexe mikrobielle Netzwerke mithilfe von maschinellem Lernen (KI/ML) überhaupt erst zu kartieren.

-

Kristin Torre Vinuesa (CFO): Als Chief Financial Officer verantwortet sie die finanziellen Geschicke des Unternehmens. Ihre Rolle ist entscheidend, um die neu eingeworbenen 30 Millionen Euro strategisch einzusetzen, den naturgemäß hohen Kapitalbedarf der anstehenden klinischen Studien („Cash Burn“) effizient zu steuern und das finanzielle Fundament für zukünftige Runden zu sichern.

- Dr. Christopher Weidenmaier (CSO): Der erfahrene Mikrobiologe (zuvor unter anderem beim US-Konkurrenten Finch Therapeutics) komplettiert das heutige Führungstrio. Als Chief Scientific Officer leitet er die präklinische Forschung und treibt das rationale Design der komplexen Bakterien-Konsortien maßgeblich voran.

Das Problem: Die Unberechenbarkeit der Natur

Um das Geschäftsmodell zu verstehen, muss man den Status quo betrachten. In der Onkologie wird aktuell intensiv mit Stuhltransplantationen (Fecal Microbiota Transplants, FMT) experimentiert. Dabei wird das Mikrobiom von Patient*innen, die hervorragend auf Krebsmedikamente ansprechen, auf „Non-Responder“ übertragen. Die Erfolge sind bemerkenswert, doch das Verfahren hat einen massiven Haken: Stuhl ist ein hochvariables Naturprodukt. Er ist schwer zu standardisieren, birgt Infektionsrisiken und lässt sich nicht als skalierbares Pharma-Produkt im industriellen Maßstab herstellen.

Hier setzt mbiomics mit sogenannten Live Biotherapeutic Products (LBPs) an. Statt auf ungefilterte Spender*innen-Transplantate zu setzen, identifiziert das Team mittels KI genau jene Bakterienstämme, die für den therapeutischen Effekt verantwortlich sind. Diese werden dann im Labor nach pharmazeutischen GMP-Standards gezüchtet und als orale Kapsel verabreicht. Es ist der Versuch, die „Blackbox“ Darm in ein berechenbares, patentierbares Medikament zu verwandeln.

Wo liegen die Risiken?

Für Beobachter*innen der Start-up-Szene bleibt das Vorhaben trotz der Millionen-Finanzierung eine Hochrisiko-Wette. Ein TechBio-Start-up in diesem Stadium hat einen enormen „Cash Burn“. Die 30 Millionen Euro sind ein starkes Fundament, doch die klinische Entwicklung in der Onkologie ist ein Langstreckenlauf, der oft dreistellige Millionenbeträge verschlingt.

Zudem ist das Geschäftsmodell hochgradig binär: Die für 2027 geplante Studie muss erst beweisen, dass die im Labor designten Bakterien-Konsortien im komplexen menschlichen Ökosystem tatsächlich die erhoffte Wirkung zeigen. Ein Scheitern des Leitkandidaten MBX-116 könnte das gesamte Vertrauen in die Plattform erschüttern. Zudem ist die Herstellung lebender Bakterien in absolut reproduzierbarer Qualität eine enorme logistische und biotechnologische Herausforderung, an der bereits andere Pioniere der Branche hängen geblieben sind.

Der Markt: Ein globales Rennen

Mbiomics ist nicht allein auf diesem Feld. Das Unternehmen muss sich gegen hochkapitalisierte internationale Konkurrent*innen behaupten:

- MaaT Pharma (Frankreich): Die Franzosen sind klinisch bereits weiter fortgeschritten und setzen auf „Full-Ecosystem“-Produkte aus gepoolten Spenderproben. Mbiomics muss beweisen, dass ihr synthetischer Präzisions-Ansatz dem natürlichen Mix überlegen ist.

- Vedanta Biosciences (USA): Ein US-Schwergewicht, das ebenfalls definierte Bakterienkonsortien entwickelt und bereits über ein breites Netzwerk an Kooperationen mit der Big-Pharma-Industrie verfügt.

Unsere Einordnung

Für das deutsche Ökosystem ist der Erfolg von mbiomics ein Leuchtturm-Signal. Dass Investoren wie MIG – die bereits bei BioNTech ein frühes Gespür bewiesen – hier massiv nachlegen, unterstreicht die Qualität des Standorts München.

Mbiomics wählt den schwierigen, aber potenziell nachhaltigeren Weg. Statt auf die bloße Kopie der Natur zu setzen, versucht das Team, das Mikrobiom durch Daten beherrschbar zu machen. Gelingt der klinische Wirksamkeitsnachweis ab 2027, könnte das Start-up nicht nur die Onkologie verändern, sondern auch Blaupausen für die Behandlung von Autoimmun- und neurodegenerativen Erkrankungen liefern. Der Weg bis dahin bleibt jedoch teuer und wissenschaftlich riskant.

Gründer*in der Woche: Vjus.AI – Vom SEO zum GEO

Wie das 2026 von Wolfe Diener gegründete Start-up Vjus.AI den Kampf um die KI-Sichtbarkeit gewinnen will.

Die Ära der klassischen Suchmaschinenoptimierung (SEO) bekommt ernstzunehmende Konkurrenz. Wenn Nutzer*innen heute nach Produkten oder Dienstleistungen suchen, tippen sie ihre Fragen zunehmend in Dialogfenster von Sprachmodellen statt in traditionelle Suchschlitze. Genau an dieser Schnittstelle positioniert sich das neu gestartete Münchner Start-up Vjus.AI. Doch kann eine Software wirklich die „Black Box“ der generativen KI entschlüsseln – und wie nachhaltig ist das Geschäftsmodell?

Hinter der am 1. April 2026 offiziell gelaunchten Plattform steht die AtWize Business Services GmbH mit Sitz in München. Kopf des Unternehmens ist Gründer Wolfe W. Diener, der zuvor bereits in leitenden Positionen als Geschäftsführer und im Vorstand großer Softwarehäuser aktiv war. Mit dem Start von Vjus.AI vollzieht das Unternehmen nun eine strategische Erweiterung in den stark wachsenden Bereich der Answer Engine Optimization (AEO) und Generative Engine Optimization (GEO).

Vom Humankapital zur KI-Sichtbarkeit

Die Historie des Unternehmens ist dabei von einem interessanten Strategiewechsel geprägt. Ursprünglich startete AtWize 2023 mit einem Fokus auf KI-Lösungen gegen den Fachkräftemangel. Diener erklärt die Hintergründe: „Parallel hatte ich schon eine Weile an der Idee arbeitete, Unternehmen zu ermöglichen, ihre in den Ruhestand ausscheidenden Mitarbeiter strukturierter zu managen, um sie bei Bedarf für Projekte oder übergangsweise anzusprechen. Es liegt so viel Humankapital und Erfahrung brach.“ In der aktuellen wirtschaftlichen Phase sei dies jedoch kein Top-Thema gewesen, weshalb man sich zunächst auf die Software-Entwicklung für Dritte konzentriert habe.

Der eigentliche „Aha-Moment“ kam durch die tägliche Arbeit. „Im letzten Jahr haben wir dann immer mehr auch KI-Tools zur Entwicklung eingesetzt und dabei den Bedarf, sogar die Notwendigkeit erkannt, die Sichtbarkeit in KI-Modellen zu messen und zu verbessern“, so Diener. Die Dringlichkeit begründet er mit dem veränderten Nutzer*innenverhalten: „KI-Modelle geben begründete Empfehlungen zur gestellten Frage. Da sucht man nicht weiter, sondern nimmt das Ergebnis wie es ist. Wer da nicht enthalten ist, ist unsichtbar.“

Nutzer*innensimulation: Die reale Perspektive

Vjus.AI setzt auf die Simulation realer Suchanfragen. Während klassische SEO-Tools oft auf APIs zugreifen, misst diese Plattform, wie Marken in Antworten von ChatGPT, Gemini, Grok oder Perplexity tatsächlich erscheinen. Auf die Frage nach der technischen Umsetzung und der Nicht-Deterministik der KI-Modelle antwortet Diener detailliert: „Wenn Sie Ihre Sichtbarkeit bei KI-Suchen wissen wollen, dann sollte diese ja so gemessen werden, wie sie ein normaler Nutzer, der einem KI-Modell eine Frage stellt, einen Prompt eingibt, auch sieht.“ Man müsse also zunächst Prompts definieren, bei denen man gefunden werden wolle – etwa als Münchner Zahnarzt bei der Frage nach dem besten Zahnarzt vor Ort.

„Wir analysieren die Ergebnisse, die von den KI-Modelle auf die Prompts hin geliefert werden“, erklärt Diener weiter. Dabei werden Kennzahlen wie Sichtbarkeit, Ranking und Sentiments (neutrale, positive oder negative Notation) erhoben. Den Vorwurf einer verzerrenden technischen Schicht weist er zurück: „Wir sind insofern keine Zwischenschicht, sondern werten die Daten aus, die viele User auch sehen würden. Die Nicht-Deterministik führt dabei zwar zu kleinen Schwankungen, aber es entsteht insgesamt ja ein Bild über die Zeit.“

Marktchancen und der „Unfair Advantage“

Das Interesse am Markt scheint groß zu sein; bereits vor dem offiziellen Launch konnten erste Kund*innen gewonnen werden. Finanziell steht das Start-up auf eigenen Beinen: „Wir finanzieren uns komplett aus eigenen Mitteln. Und da wir schon Kunden im Entwicklungsbereich haben, konnten wir Vjus.AI früh anwenden und testen“, betont der Gründer. Mit Investor*innen habe man noch nicht gesprochen: „Jetzt erst mal machen, dann reden wir.“

Um sich gegen die großen SEO-Platzhirsche zu behaupten, setzt Diener auf vier spezifische technische Vorteile. Erstens setze man auf eine natürliche Simulation: „Unsere Art des Promptens simuliert wirklich natürliche User. Andere machen das nicht.“ Zweitens komme eine eigene Scraping-Technologie zum Einsatz. Diese erlaube eine besonders detaillierte Analyse der Ergebnisse, auch der „Nebengeräusche“ wie etwa Quellenangaben. Als dritten Punkt nennt der Gründer das analytische Prompting: Vjus.AI unterstützt nicht nur beim Erstellen von Prompts, sondern analysiert auch, wie passend diese für die Sichtbarkeitsmessung sind. Viertens biete das Improver-Modul ein Analyse-Tool, das über die Daten hinweg ermittelt, „was die Haupthebel für das Unternehmen oder die Marke ist, um die Sichtbarkeit bei KI-Suchen zu erhöhen“.

GEO als neues Standard-Tool?

Für die Zukunft sieht Diener eine klare Entwicklung. Zwar werde es in zwei Jahren wahrscheinlich immer noch die klassische Google-Suche geben, doch der Übergang sei bereits fließend, da Google zunehmend KI-Ergebnisse mitliefere. „Die Suche mit KI-Modellen wird aber die gewohnte Praxis werden“, ist sich Diener sicher.

Seine Prognose für die Branche ist deutlich: „Insofern wird SEO eher übergehen in ein GEO. Ein SEO ohne Beachtung der Optimierungen für KI-Modelle macht aus meiner Sicht aber heute schon keinen Sinn mehr.“ Das Ziel für Vjus.AI ist dabei klar gesteckt. Die größte Hürde sei es, für die Nutzer*innen den besten Mehrwert zu generieren: „Darauf liegt unser Fokus und deshalb rennen wir, so schnell wir können.“

Vom Assekuradeur zum Cyber-Abwehrzentrum: Baobabs riskante Wette auf die All-in-One-Lösung

Es ist ein mutiger Schritt für ein junges Unternehmen: Das 2021 in Berlin gegründete InsurTech Baobab Insurance streift sein reines Versicherungs-Image ab und firmiert ab sofort unter dem Namen Baobab Risk Solutions (BRS). Zeitgleich führt das Start-up einen eigenen Managed Detection and Response (MDR) Service ein. Damit will das Unternehmen künftig nicht mehr nur den finanziellen Schaden bei Cyberangriffen abfedern, sondern die Angriffe selbst aktiv abwehren. Ein ambitionierter Plan, der das Geschäftsmodell unter enormen Leistungsdruck setzt.

„Unser neuer Name ist ein Versprechen an den Markt: Wir bieten keine bloßen Policen, sondern eine ganzheitliche Strategie gegen digitale Risiken“, erklärt Mitgründer und Geschäftsführer Vincenz Klemm. Prävention, Abwehr und Versicherung sollen fortan eine untrennbare Einheit bilden. Auf die Vermutung, das reine Versicherungsgeschäft sei für den Mittelstand schlichtweg zu unprofitabel geworden, kontert der Gründer deutlich: „Der Wechsel zu Risk Solutions ist weit mehr als ein neues Branding. Damit lösen wir unser Gründungsversprechen konsequent ein.“ Die bloße Police sei nie das Endprodukt gewesen, der Schritt zum aktiven Abwehrdienstleister sei von Tag eins an auf der Roadmap gestanden. Klemm fasst die neue Ausrichtung in einem klaren Kernsatz zusammen: „Wir warten somit nicht darauf, dass ein Schaden reguliert werden muss. Wir sorgen stattdessen aktiv dafür, dass er gar nicht erst entsteht.“ Dies sei kein Ausstieg aus der Versicherung, sondern die Evolution zum echten Risikomanagement für den Mittelstand und Industrieunternehmen.

Vom Millionen-Exit zum Cyber-Schutzschild

Um die Ambitionen von Baobab Risk Solutions zu verstehen, lohnt ein Blick auf das Gründer-Duo. Vincenz Klemm (Geschäftsführer) und Anton Foth (CTO) bringen geballte Erfahrung mit. Klemm baute in den USA den digitalen Makler Gabi auf und verkaufte ihn für rund 320 Millionen US-Dollar an Experian, während Foth als ehemaliger CTO von Coya (später Luko) die tiefe technische Expertise für datengetriebene Versicherungsmodelle liefert. Gestartet mit rund 4,2 Millionen US-Dollar Pre-Seed-Kapital, ist das Unternehmen mittlerweile in Deutschland, Österreich und den Benelux-Ländern aktiv.

Der Aufbau eines europäischen Assekuradeurs in den vergangenen fünf Jahren verlief dabei nicht ohne Hürden. „Eine europäische Expansion ist niemals eine reine Blaupause“, räumt Klemm ein. Um regulatorische Fallstricke frühzeitig zu erkennen, setze man gezielt auf lokale Expertise wie den General Manager für die Benelux-Staaten, Tim van Lier. Als größten Trumpf sieht Klemm jedoch die eigene Reaktionsgeschwindigkeit: „Wenn etwas nicht funktioniert, korrigieren wir es binnen Tagen, statt in monatelangen Release-Zyklen zu verharren.“ Auch die Frage nach frischem Kapital für den nun extrem kostenintensiven MDR-Betrieb wischt er routiniert beiseite: Man sei durch die letzte Finanzierungsrunde hervorragend aufgestellt. Sollte man dennoch nachlegen müssen, wisse man Investoren an der Seite, die „bei positiven Trends extrem schnell Kapital mobilisieren können.“

Der neue Vorstoß: MDR und ein 24/7-Defense-Center

Die Argumente für den neuen, zubuchbaren MDR-Service stützen sich auf drastische Marktveränderungen. Laut dem CrowdStrike Global Threat Report 2026 erfolgen 82 Prozent aller Angriffe mittlerweile ohne klassische Schadsoftware, woran Standard-Antivirus-Programme oft scheitern. Baobabs Antwort darauf ist ein rund um die Uhr besetztes Security Operations Center (SOC). Die Ansagen des Start-ups sind selbstbewusst: Mit einer Erkennungsrate von 99 Prozent identifiziere man Bedrohungen bereits in der Entstehungsphase. Die hauseigene Deep-Scan-Technologie arbeite 3,2-mal effektiver als herkömmliche Scans, zudem liege die Angriffsfrequenz bei Bestandskund*innen um 77 Prozent unter dem Marktdurchschnitt. Ergänzt wird das Ganze durch Dark Web Monitoring.

Doch wie kann ein Start-up im Angesicht des globalen Fachkräftemangels in der Cybersecurity personell und technologisch mit staatlich finanzierten Hacker-Syndikaten mithalten? Klemm verweist auf das ambitionierte Umfeld: Weil das Team Kunden aktiv berate und nicht nur stumpf Risiken überwache, habe man sich als Top-Adresse für Talente etabliert. Gleichzeitig gibt er sich pragmatisch und räumt ein, dass man nicht alles allein stemmen kann: „Um personelle Spitzen abzufangen, kooperieren wir mit hochprofessionellen Technologiepartnern.“ Diese Hybridstrategie sichere die Skalierbarkeit und den Zugang zu führender Technologie. Das absolute Kernversprechen an den Kunden tastet er dabei jedoch nicht an: „Die Analyse und der direkte Kontakt bleiben immer bei uns.“

Genial verzahnt oder überhoben?

In der Theorie ist die Verknüpfung von aktiver Abwehr und Versicherung genial: Versagen die Abwehrmaßnahmen von Baobab, muss die Versicherung den finanziellen Schaden ohnehin tragen – die Interessen von Kund*in und Versicherer sind maximal synchronisiert. In der Praxis gleicht der Betrieb eines 24/7-SOC jedoch einem Hochseilakt, der extrem personal- und kostenintensiv ist. Zudem droht ein massives Klumpenrisiko, falls ein neuartiger Zero-Day-Exploit die Filterlogik umgeht und hunderte Mittelständlerinnen gleichzeitig kompromittiert werden.

Auf dieses „All-Eggs-in-One-Basket“-Szenario angesprochen, reagiert Klemm unaufgeregt und verweist auf die harten Realitäten der Branche: „In der Cybersecurity gibt es keine hundertprozentige Sicherheit. Daher stellt ein neuartiger Zero-Day-Exploit für die gesamte Branche grundsätzlich ein Kumulrisiko dar.“ Doch genau dieses Risiko trage man als Assekuradeur über die Policen ohnehin bereits. Der MDR-Service sei kein zusätzliches Risiko, sondern ein Schutzschild. „Anstatt die Gefahr zu vergrößern, reduziert unsere aktive Abwehr die Wahrscheinlichkeit, dass ein solches Ereignis überhaupt zum Tragen kommt“, argumentiert der Geschäftsführer. Und wenn alle Stricke reißen? „Die Versicherungspolice ist der finale Sicherheitsanker für den reinen Risikotransfer“, stellt er klar.

Markt & Wettbewerb: Kampf der Titanen

Im Mid-Market-Segment tritt das Berliner Team gegen globale Giganten wie Munich Re oder spezialisierte Cyber-MGAs wie das US-Einhorn Coalition an. Auch der Markteintritt US-amerikanischer Riesen in Europa beunruhigt Klemm nicht – im Gegenteil: „Der Markteintritt globaler Akteure unterstreicht vor allem eines: Das enorme Potenzial des europäischen Cybermarktes.“

Die Marschroute für die kommenden 12 bis 18 Monate ist klar gesteckt. Man wolle die Verzahnung von Vorfallsreaktion (Incident Response) und MDR weiter vertiefen und die Schadenquote weiter unter den Marktdurchschnitt drücken. Der entscheidende Hebel soll jedoch die Radikalvereinfachung des Versicherungsabschlusses werden. „Unser Ziel: Der Abschluss einer Cyberversicherung oder Vertrauensschadenversicherung muss so einfach werden wie nie zuvor – für Makler und Kunden“, verspricht Klemm. Gegen die übermächtige Konkurrenz will er nicht durch schiere Finanzkraft gewinnen: „Wir gewinnen diesen Wettbewerb nicht über das größte Marketingbudget, sondern über das beste Risikomanagement und die engste Partnerschaft mit dem Mittelstand.“

Für die Branche ist Baobab damit ein spannendes Lehrstück über die Vertikalisierung von Geschäftsmodellen. Schaffen es die Berliner, ihr technologisches Versprechen zu halten, bauen sie eine hochprofitable Cybersecurity-Festung für den europäischen Mittelstand. Scheitert die Technik jedoch an der Realität komplexer Cyberbedrohungen, droht das gesamte Modell unter den eigenen Schadensquoten zu kollabieren. Es bleibt ein riskantes, aber zukunftsweisendes Play.

Nox Mobility: 2 Mio. EUR für den "Flugzeug-Killer" auf Schienen

Das Berliner Start-up Nox Mobility will mit privaten Zimmern im Nachtzug europäische Kurzstreckenflüge ersetzen. Eine 2-Millionen-Euro-Pre-Seed-Runde gibt erste Starthilfe. Doch der europäische Bahnmarkt ist ein hartes Pflaster für Gründende – erst 2024 scheiterte ein französischer Konkurrent mit exakt demselben Konzept. Eine Einordnung.

Es ist ein mutiges Versprechen in einem der am stärksten regulierten Märkte Europas: Das 2025 gegründete Mobilitäts-Start-up Nox Mobility will das europäische Nachtzug-Erlebnis revolutionieren. Dafür hat das Unternehmen nun eine Pre-Seed-Finanzierungsrunde in Höhe von 2 Millionen Euro abgeschlossen. Angeführt wird die Runde vom Frühphasen-Investor IBB Ventures. Mit an Bord sind zudem der italienische Investor Tommaso Lucca sowie Branchenköpfe wie HomeToGo-Mitgründer und CEO Dr. Patrick Andrae. Das frische Kapital soll primär in den Teamaufbau, die Vorbereitung der ersten Strecken für das Jahr 2027 sowie den Bau eines originalgetreuen Mockups der Zugkabinen fließen.

Rollendes Boutique-Hotel statt Abteilromantik

Während Nachtzüge aktuell zwar einen massiven Nachfrageboom erleben, ist der eigentliche Markt laut Nox Mobility zwischen 2001 und 2019 drastisch geschrumpft – von rund 1.200 wöchentlichen Verbindungen in Europa auf nur noch etwa 450. Nox will diese Lücke nun schließen und positioniert sich explizit nicht als klassisches Bahnunternehmen, sondern als direkte Alternative zum Kurzstreckenflug.

Der Clou: Das traditionelle Teilen von Schlafabteilen mit Fremden entfällt; stattdessen bekommt bei Nox Mobility jede(r) Reisende sein eigenes privates Zimmer mit Schlafplatz. Die Reise verbinde laut Nox die Zuverlässigkeit des Fliegens operativ mit dem Gefühl eines Boutique-Hotels. Abfahrten sollen abends an zentralen Bahnhöfen stattfinden, die Ankunft morgens direkt im Stadtzentrum – Flughafentransfers und Sicherheitskontrollen entfallen. Zielgruppe sind neben Freizeitreisenden vor allem Geschäftsreisende, für die eine Zugfahrt den frühen Abflug und eine zusätzliche Hotelübernachtung ersetzen soll. Preislich will Nox auf dem Niveau vergleichbarer Flugreisen agieren.

Das Gründerteam: Reichweite trifft auf operative Härte

Hinter dem Projekt steht ein Trio, das Branchenerfahrung, Skalierungswissen und bereits jetzt eine enorme Zielgruppe vereint:

Artur Hasselbach bringt als Mitgründer des Payment-Fintechs orderbird – das für über 140 Millionen Euro von Nexi übernommen wurde – ausgewiesene VC- und Tech-Erfahrung mit.

Janek Smalla kennt das harte operative Mobilitätsgeschäft aus seinen vorherigen Stationen bei FlixTrain und dem Mobilitätsanbieter Bolt.

Thibault Constant ist in der Nische ein Star: Mit "Simply Railway" hat er eine der größten Eisenbahn-Communities Europas mit über 600.000 Abonnenten aufgebaut. Er kennt die Probleme der Fahrgäste aus unzähligen Gesprächen und Zugfahrten aus erster Hand.

Die Gründer geben sich selbstbewusst und verkünden, das Rollmaterial für die Züge bereits gesichert zu haben.

Unsere Markteinordnung

Für uns stellt sich jedoch eine zentrale Frage: Kann man mit 2 Millionen Euro Pre-Seed-Kapital tatsächlich einen hochkomplexen Bahn-Infrastrukturbetrieb aufbauen? Die Antwort lautet: Nein, es ist lediglich das Ticket, um überhaupt an den Start zu gehen. Der Bau eines Mockups in Originalgröße ist das eine – die Finanzierung und Zulassung echter Züge für den Betrieb ab 2027 kostet schnell dreistellige Millionenbeträge.

Besonders kritisch wird das Vorhaben mit Blick auf die Konkurrenz und die jüngere europäische Start-up-Historie. Die Idee eines rollenden Hotels mit ausschließlich privaten Abteilen ist nicht neu. Das französische Start-up Midnight Trains startete 2020 mit extrem viel PR und fast exakt demselben Geschäftsmodell. Im Juni 2024 musste das Projekt jedoch Insolvenz anmelden. Die Gründer scheiterten daran, dass europäische VCs und Banken das massive finanzielle Risiko nicht tragen wollten und die europäische Schieneninfrastruktur historisch stark auf staatliche Monopolisten zugeschnitten ist, was neue Player systematisch benachteiligt.

Gleichzeitig schläft der etablierte Markt nicht: Die Österreichischen Bundesbahnen (ÖBB) dominieren mit ihrem Nightjet das Geschäft und haben mit ihren neuen „Mini Cabins“ (Schlafkapseln für Einzelpersonen) bereits auf den Wunsch nach mehr Privatsphäre reagiert.

Eine hochriskante Kapitalwette

Nox Mobility löst zweifellos ein echtes Problem und trifft den Nerv der Zeit in Sachen nachhaltiger Mobilität. Das Team aus Hasselbach, Smalla und Constant ist hervorragend aufgestellt und die Tatsache, dass sie nach eigenen Angaben bereits Züge gesichert haben, könnte der entscheidende Wettbewerbsvorteil gegenüber gescheiterten Projekten wie Midnight Trains sein.

Dennoch bleibt Nox Mobility eine hochriskante Kapitalwette. Die spannende Bewährungsprobe für das Berliner Start-up beginnt nicht erst 2027 auf den Schienen, sondern bereits in der nächsten Finanzierungsrunde: Dann wird sich zeigen, ob das Team Investor*innen davon überzeugen kann, die enormen Summen für den realen Bahnbetrieb aufzubringen – oder ob der Traum vom Start-up-Nachtzug im Trassendschungel Europas stecken bleibt.

Schluss mit Kaskodenken: Was der neue Innovationsrat Gründer*innen bringt

Pünktlich zur Hannover Messe formiert sich ein neues Schwergewicht in der deutschen Technologiepolitik: Acht Expertinnen und Experten haben den ehrenamtlichen „Innovationsrat für Deutschland“ ins Leben gerufen. Getragen von der VDI-Initiative „Zukunft Deutschland 2050“ und der Gesellschaft für Informatik (GI) bündelt das Gremium die Stimmen von über 160.000 Ingenieur*innen und Informatiker*innen.

Die Diagnose des Rats fällt drastisch aus: Deutschland verliere im globalen Wettbewerb an Verbindlichkeit und Umsetzungsgeschwindigkeit. Für die Gründer*ionnenszene birgt das Manifest vielversprechende Forderungen – es stellt sich jedoch auch die Frage, ob ein weiteres Gremium die strukturelle Risikoaversion des Standorts durchbrechen kann.

Das Kernproblem: Erfunden in Deutschland, skaliert im Ausland?

Das zentrale Narrativ des Innovationsrats trifft einen wunden Punkt der heimischen Start-up-Ökonomie: Es dürfe nicht länger passieren, dass Schlüsseltechnologien zwar in deutschen Forschungslaboren erfunden, aber aufgrund fehlenden Kapitals oder restriktiver Regulierung im Ausland skaliert werden. Der Rat fordert in seinen „5 Impulsen“ eine fundamentale Neuausrichtung:

- Schluss mit dem Legislaturperioden-Takt: Innovationspolitik muss langfristig und faktenbasiert gedacht werden, nicht in kurzatmigen Wahlzyklen.

- Regulierung als Enabler statt als Bremse: Die Expert*innen fordern den Abbau von europäischem „Goldplating“ (der innovationsfeindlichen Übererfüllung von EU-Normen durch nationale Gesetze) und die Schaffung echter Experimentierräume und Reallabore.

- Mut statt „Kaskodenken“: Anstatt risikoscheu zu agieren, müssen strategische Investitionen in Schlüsseltechnologien fließen. Die Rahmenbedingungen für Scale-ups müssen massiv verbessert werden, um industrielles Skalieren im eigenen Land zu ermöglichen.

Die Köpfe hinter dem Innovationsrat für Deutschland

Die Zusammensetzung des Gremiums unterstreicht den Anspruch, Technologie, Recht und Wirtschaft zusammenzudenken:

- Prof. Dr. Lutz Eckstein: VDI-Präsident und Experte für automatisiertes Fahren an der RWTH Aachen.

- Prof. Dr. Veronika Grimm: Professorin an der TU Nürnberg und als „Wirtschaftsweise“ eine der prägendsten Stimmen der Energiepolitik.

- Prof. Dietmar Harhoff, PhD: Direktor am Max-Planck-Institut für Innovation und Wettbewerb sowie langjähriger EFI-Vorsitzender.

- Prof. Dr. Jürgen Kühling: Regulierungs- und Wettbewerbsexperte sowie ehemaliger Vorsitzender der Monopolkommission.

- Dr. Anne Lamp: Gründerin und Pionierin im Bereich Circular Economy.

- Dr. Melanie Maas-Brunner: Industrielle Forschungsexpertin, ehemalige BASF-Vorständin und designierte Präsidentin des Stifterverbands.

- Adrian Willig: Direktor des VDI mit Fokus auf Ingenieurkompetenzen und Technikstandort-Förderung.

- Prof. Dr. Martin Wolf: Präsident der Gesellschaft für Informatik und Experte für intelligente Produktionssysteme.

Im Start-up-Fokus: Dr. Anne Lamp und der harte Weg der Skalierung

Dass der Innovationsrat nicht nur aus der wissenschaftlichen Helikopterperspektive agiert, zeigt eine entscheidende Personalie: Dr. Anne Lamp sitzt am Tisch. Die CEO und Mitgründerin des Hamburger Start-ups traceless materials steht wie kaum eine andere für die Herausforderungen der industriellen Kreislaufwirtschaft.

Im Jahr 2020 ins Leben gerufen, hat traceless ein vollständig biobasiertes Granulat aus Agrar-Reststoffen entwickelt, das als Alternative zu Plastik dient und unter natürlichen Bedingungen in nur zwei bis neun Wochen kompostierbar ist. Lamp, 2022 mit dem Deutschen Gründerpreis ausgezeichnet und 2025 für den Deutschen Zukunftspreis nominiert, hat ihr Unternehmen erfolgreich aus dem Labor geholt. Mit der Realisierung einer groß angelegten Demonstrationsanlage hat das Start-up das für Hardware-Gründungen berüchtigte „Tal des Todes“ gemeistert. Mit der geplanten Industrieanlage soll die Kapazität künftig um ein Vielfaches gesteigert und das Material massentauglich gemacht werden. Lamps Vita verkörpert exakt das, was der Rat nun auf politischer Ebene einfordert: Die erfolgreiche Überführung nachhaltiger Technologien von der Erfindung in die marktfähige, industrielle Skalierung.

Unsere Einordnung: Ein weiteres Gremium oder echter Hebel?

Die entscheidende Frage für Gründer*innen und Start-ups bleibt: Bewirkt dieser Rat wirklich etwas? An technologiepolitischen Beiräten mangelt es der Bundesrepublik traditionell nicht. So sitzt mit Prof. Dietmar Harhoff bezeichnenderweise der langjährige Vorsitzende der bereits existierenden Expertenkommission Forschung und Innovation (EFI) der Bundesregierung ebenfalls in diesem neuen Gremium.

Dennoch hat der Innovationsrat zwei strategische Vorteile: Er ist explizit unabhängig von Parteien und Einzelinteressen der Wirtschaft und vereint mit dem VDI und der GI die geballte Umsetzungskompetenz der technischen Basis. Die Visionen sind ambitioniert – etwa die Forderung, vertrauenswürdige KI als „Trained in Germany“ zu einem neuen globalen Gütesiegel aufzubauen.

Für Deep-Tech- und Hardware-Start-ups wird der Rat jedoch nicht an der bloßen Anzahl seiner künftigen Stellungnahmen gemessen werden, sondern daran, ob seine Impulse tatsächlich in den Maschinenraum der Politik vordringen. Erst wenn das geforderte Kapital für die Wachstumsphase fließt und Genehmigungsverfahren radikal entschlackt werden, wird das „Kaskodenken“ wirklich der Vergangenheit angehören.

UniteLabs: Der Münchner DeepTech-Herausforderer auf dem Weg zum globalen Labor-Standard?

Das 2024 von Robert Zechlin, Lukas Bromig und Julian Willand gegründete UniteLabs will die Laborautomatisierung von proprietären Hürden befreien. Nach einer Millionenfinanzierung folgte Anfang 2026 der offizielle US-Launch. Wir wollten wissen: Wie realistisch ist die Vision eines herstellerunabhängigen Standards in einem von Hardware-Silos dominierten Markt? Eine Analyse.

Wer heute ein hochmodernes BioTech-Labor betritt, erwartet nahtlos vernetzte HighTech-Forschung. Die Realität sieht oft anders aus: Rund 90 Prozent der Laborgeräte stammen von unterschiedlichen Hersteller*innen und sprechen schlichtweg nicht dieselbe technische Sprache. Um künstliche Intelligenz in der Forschung nutzbar zu machen, müssen hochqualifizierte Wissenschaftler*innen oft als Software-Ingenieur*innen einspringen und mühsam Schnittstellen programmieren. Genau diesen Flaschenhals will das Münchner DeepTech-Start-up UniteLabs beseitigen.

Die Gründer und der Sprung aus München

Hinter UniteLabs stehen Robert Zechlin, Lukas Bromig und Julian Willand. Nach Vorarbeiten ab 2022 wurde das Unternehmen 2024 offiziell gegründet. Das Team vereint interdisziplinäre Expertise aus Chemieingenieurwesen, Wirtschaftsinformatik und Unternehmensstrategie – eine essenzielle Mischung für ein Produkt, das tiefes Prozessverständnis mit modernster Softwarearchitektur verbinden muss.

Dass die Idee einen massiven Schmerzpunkt der Industrie trifft, zeigt die rasante Entwicklung der letzten Monate. Nach einer Pre-Seed-Finanzierungsrunde in Höhe von 2,77 Millionen Euro unter der Führung von NAP (ehemals Cavalry Ventures) im Januar 2025 und der Auszeichnung als „Bestes Münchner Start-up“ beim Munich Startup Award 2025 ist das Unternehmen sichtlich gewachsen. Im ersten Quartal 2026 zählt das Team im Münchner Inkubator Werk1 bereits rund 28 Köpfe.

Doch wie verhindert ein derart rasant wachsendes Team, bei der ständigen Anbindung neuer, exotischer Hardware nicht zu einer hochbezahlten IT-Manufaktur zu verkommen? Schließlich erfordert jedes neue Laborgerät auf dem Markt zunächst einmal Entwicklungsaufwand für den passenden Konnektor.

„Unser Ziel ist nicht, jedes exotische Gerät einzeln ‚irgendwie‘ anzubinden“, stellt Mitgründer Robert Zechlin klar. Vielmehr soll die Integration zu einer wiederholbaren Produktfähigkeit reifen. Statt sich im Klein-Klein der Modellnummern zu verlieren, baue UniteLabs seine Konnektoren entlang grundsätzlicher Geräte-Fähigkeiten. Die puren Herstellerspezifika landen dabei in einer dünnen Adapter-Schicht, während Workflows und Datensemantik konsistent bleiben.

Um die berüchtigte Skalierungsfalle zu umgehen, setzt das Start-up zudem verstärkt auf „Reusable Automation Assets“. „Wir investieren in validierte Workflow-Bausteine, Device-Profile und Test-Suites, mit denen die zweite und dritte Integration deutlich schneller wird als die erste“, betont Zechlin und skizziert damit den Weg zum echten SaaS-Unternehmen. Der Gründer gibt die Richtung selbstbewusst vor: „Die Grenzkosten für das nächste Gerät und den nächsten Standort müssen über Zeit sinken. Unser Endzustand ist ein Ökosystem, in dem Integrationen gemeinsame Infrastruktur sind, nicht Projektgeschäft.“

Vom Prototyp zur Architektur der offenen Labore

Im Februar 2026 hat UniteLabs auf der renommierten Branchenmesse SLAS in Boston den offiziellen US-Launch seines „AI-Ready Lab Automation Systems“ vollzogen. Statt nur isolierte Schnittstellen zu flicken, positioniert sich das Start-up nun mit einer klaren, dreiteiligen Architektur.

Den Kern bildet die Cloud-native „UniteLabs Platform“, die Hardware vernetzt und die Integration von Machine-Learning-Modellen in Echtzeit erlaubt. Ergänzt wird dies durch die lokale Anwendung „GroundControl“ für den Plug-and-Play-Anschluss von Geräten sowie das „UniteLabs SDK“. Letzteres ist ein Python-Werkzeug für Wissenschaftler*innen, um Labor-Workflows komplett als Code zu steuern. Dass diese Theorie praxistauglich ist, beweist das aufstrebende KI-BioTech-Unternehmen Cradle, das die Lücke zwischen Maschinen und digitalen Daten-Lakes intern bereits mit dem Münchner System schließt. Laut UniteLabs soll sich der Labor-Durchsatz für solche KI-getriebenen Forschungsteams durch die Plattform um bis zu das Vierfache steigern lassen.

Ein „Lab-as-Code“-Ansatz via Python mag für entwickleraffine Data Scientists verlockend sein – doch schließt er nicht paradoxerweise die klassischen Biolog*innen aus, für die Code-Workflows oft eine zu steile Lernkurve bedeuten?

„Code ist nicht das Produkt“, kontert Zechlin. Er sei vielmehr eine Schnittstelle, die sowohl Power-User als auch den Laboralltag bedienen müsse. Das SDK richte sich an Teams, die volle Kontrolle über Versionierung und automatisierte Tests verlangen – was im KI-BioTech-Umfeld zunehmend Standard sei. Zechlin räumt jedoch ein, dass das Programmieren nicht jedem liege: „Die meisten wollen zuverlässige Ausführung und klare Transparenz.“

Die Lösung der Münchner: Über die Orchestrierungsschicht und „GroundControl“ werden Workflows paketiert und mit Leitplanken versehen, sodass sie auch für Nicht-Entwickler sicher ausführbar sind. Code bleibt strategisch zwar die „universelle Abstraktion“ über Geräte hinweg, doch das Interface der Zukunft sieht anders aus. Zechlin blickt voraus: „Das User Interface für Wissenschaftler wird zunehmend KI-gesteuert und natürliche Sprache zum primären Interface. UniteLabs dient diesen KI-Applikationen als robuste Surface Area und Source of Truth.“ Die Leitplanke für das Wachstum fasst er in einem Satz zusammen: „Unsere Vision ist: flexibel, wo es Sinn macht, und kompromisslos robust, wo es zählen muss.“

Die Bewährungsprobe auf dem US-Markt

Nach dem Bostoner Launch steht das Start-up nun vor der monumentalen Aufgabe, sich im hochkompetitiven US-Markt zu behaupten. Hier entscheidet sich, ob UniteLabs vom europäischen Hoffnungsträger zum globalen Player reift. Umgeben von gigantischen Investitionen in die KI-Wirkstoffentwicklung reicht es nicht, nur ein weiteres Automatisierungstool zu sein – UniteLabs muss sich als essenzieller „Schaufelhersteller“ für den aktuellen Boom etablieren.

Dabei trifft man auf amerikanische Wettbewerber*innen, die teils mit hunderten Millionen Dollar Venture Capital ausgestattet sind. Wie überlebt ein Münchner Start-up mit einer Pre-Seed-Runde von knapp drei Millionen Euro diese Materialschlacht? Zechlin gibt sich pragmatisch und weicht dem direkten Finanz-Vergleich aus: „Klar: In Infrastrukturmärkten hilft Kapital, aber es ist nicht der entscheidende Hebel.“ Anstatt die Konkurrenz im reinen „Spend“ schlagen zu wollen, baue man auf messbaren Nutzen im Laborbetrieb.

Der Plan scheint aufzugehen: Ein Großteil von Umsatz und Pipeline stammt heute bereits aus den USA, wo UniteLabs Kund*innen an beiden Küsten bedient und mit großen Hardware-Hersteller*innenn kooperiert. „Wir planen für dieses Jahr unseren ersten Big Pharma Roll-out, der sowohl in Europa als auch an Standorten in den USA erfolgen soll“, verrät der Gründer. Um diese Dynamik zu finanzieren, hebe man aktuell eine 9-Millionen-Euro-Seed-Runde für die US-Expansion. Den strukturellen Wettbewerbsvorteil sieht Zechlin in der herstelleragnostischen Verbindung bestehender Geräte: „Statt Rip-and-Replace zu verlangen, werden Workflows schneller produktiv, Daten werden sauber mit Kontext versehen, und Teams können ‚Lab-as-Code‘ wirklich ausrollen.“

Ein strategischer Hebel ist dabei die Zielgruppenansprache. Statt in endlosen Vertriebszyklen mit dem C-Level großer Pharma-Konzerne zu ringen, treibt UniteLabs ein nutzer*innengetriebenes Wachstum voran. Labor-Ingenieur*innen, die durch das Python-SDK wochenlange Schnittstellenprogrammierung einsparen, tragen das System organisch in ihre Unternehmen. Dabei profitiert das Start-up enorm davon, selbst keine Pipettierroboter oder Analysegeräte herzustellen. Als „neutrale Schweiz“ der Labor-Hardware buhlt UniteLabs nicht um lukrative Geräteverkäufe – ein extrem starkes Argument gegen den gefürchteten Vendor-Lock-in amerikanischer Hardware-Giganten.

Stresstest für das Geschäftsmodell und Regularien

Doch die ambitionierte Plattform-Strategie wird kritisch geprüft werden. Das Geschäftsmodell birgt ein ständiges API-Katz-und-Maus-Spiel, da Schnittstellen zu teils stark abgeschirmten Systemen gebaut werden müssen. Wenn etablierte Hersteller*innen ihre Firmware ändern oder Drittanbieter-Zugriffe blockieren, explodieren schnell die Wartungskosten für die Konnektoren.

Bleibt die Frage an den Gründer: Was ist also der Plan B, wenn die Marktführer ihre Schnittstellen per Update plötzlich aktiv verschlüsseln? Reicht der Verweis auf offene Standards wie das SiLA2-Protokoll in der harten Praxis aus?

„Wir gehen davon aus, dass Hersteller ihre Ökosysteme schützen werden. Unsere Strategie darf deshalb nicht auf ‚Goodwill‘ bauen“, gibt sich Zechlin keinen Illusionen hin. Standards wie SiLA2 seien zwar hilfreich gegen Fragmentierung, aber „kein Schutzschild“. Der Ansatz der Münchner ist stattdessen pragmatisch und mehrstufig: Standards nutzen, wo verfügbar, und eigene robuste Adapter bauen, wo nötig. Zudem betreibe man ein Programm mit automatisierten Regressionstests am realen Geräteverhalten, um Fehler durch Updates früh zu erkennen.

Der zweite Baustein der Verteidigung ist kommerzieller Druck. Da Labore zunehmend „Best-of-Breed“-Lösungen kombinieren wollen, würden Hersteller, die Interoperabilität blockieren, zunehmend Deals riskieren. Im Hintergrund investiere man deshalb viel Arbeit in aktiv gepflegte Partnerschaften mit den Produzent*innen. Zechlins Plan B lautet letztlich Resilienz: „Mehrere Integrationspfade, starke Tests, und ein System, das stabil bleibt, auch wenn sich die Oberfläche verändert.“ Er ist sich sicher: „Langfristig wirkt die Ökonomie in Richtung Offenheit.“

Neben blockierender Hardware bleibt die US-Zulassungsbehörde FDA die vielleicht höchste Hürde auf dem Weg in den Enterprise-Markt. Deren strenge Vorgaben zu elektronischen Aufzeichnungen sind der größte Vorbehalt von Pharmaunternehmen gegenüber Cloud-basierten Systemen. Gelingt es UniteLabs, Offenheit mit lückenlosen Audit-Trails zu verknüpfen, könnten sie die berüchtigten Sales-Zyklen drastisch verkürzen.

Doch wie passt maximale Entwickler*innen-Freiheit durch Python-Skripte mit rigider FDA- und GxP-Compliance zusammen? Für Zechlin existiert dieser Widerspruch im Labor-Alltag schlichtweg nicht: „Compliance widerspricht Flexibilität nicht. Was widerspricht, ist unkontrollierte Veränderung.“

Um Big Pharma gerecht zu werden, behandle man hochflexible Workflows wie reguläre Software-Produkte: versioniert, testbar und auditierbar. „Ein Script ist in einem GxP-Kontext kein ‚jeder macht, was er will‘, sondern ein kontrolliertes Artefakt mit definierten Inputs, erwarteten Outputs und einem Validierungsnachweis“, unterstreicht der Mitgründer. Die Plattform trenne Sandbox-Entwicklungen von einer strikt kontrollierten Produktionsebene mit signierten Releases, Environment-Pinning und klarer Datenlineage. Zechlin formuliert einen selbstbewussten Anspruch an die Branche: „Das Labor holt Software-Best-Practices nach. Unser Anspruch ist, ‚compliant by design‘ zur Default-Einstellung für AI-ready Lab Ops zu machen.“

Fazit

UniteLabs hat exzellentes Timing bewiesen. Die BioTech-Branche lechzt nach KI, scheitert aber noch massenhaft an isolierten Daten. Durch das Bereitstellen essenzieller Daten-Infrastruktur haben sich die Münchner in eine starke Ausgangsposition manövriert. Der US-Launch und anstehende Messepräsentationen zeugen vom Anspruch der Gründer. Der ultimative Lackmustest ab 2026 wird jedoch sein, ob die Hardware-Hersteller*innen diesen Wandel dulden – oder den Kampf um ihre lukrativen Software-Margen eröffnen.

Bleibt die Frage nach dem viel zitierten „Endgame“: Baut das Start-up wirklich das globale Betriebssystem für Biotech-Labore, oder macht man sich letztlich nur als hochattraktives Übernahmeziel für Hardware-Giganten hübsch?

Auf diese Entweder-Oder-Frage antwortet Zechlin diplomatisch, aber ambitioniert: „Unsere Vision ist, die neutrale Betriebsschicht für moderne Labore zu werden, weil die Branche einen herstellerunabhängigen Standard braucht, nicht noch ein weiteres Einzellösungstool.“ Gleichzeitig sei man Realist: Infrastruktur zähle nur, wenn sie im Alltag zuverlässig genutzt werde und verlässliche, strukturierte Daten für KI liefere.

Sollte das gelingen, hält sich UniteLabs alle Optionen offen – von der unabhängigen Kategorie-Definition über strategische Partnerschaften bis hin zum Exit. Doch auf einen schnellen Verkauf schiele man nicht, verspricht Zechlin: „Wir bauen nicht für eine Übernahme. Wir bauen so, dass der Markt die Plattform ernst nehmen muss.“ Und am Ende solle ohnehin der/die Kund*in profitieren: „Weniger Silos, schnellere Science, und ein Ökosystem, in dem Innovation nicht an proprietären Schnittstellen hängen bleibt.“

Strategischer Exit: food42morrow übergibt seine Getränkemarke JUMA an die Berentzen-Gruppe

Die Konsolidierung im Markt für funktionale Getränke setzt sich fort: die 2022 gegründete food42morrow GmbH übergibt ihre Marke JUMA im Rahmen eines strategischen Exits an die Vivaris Getränke GmbH & Co. KG, eine Tochtergesellschaft der börsennotierten Berentzen-Gruppe Aktiengesellschaft. Ab Mai 2026 soll die großflächige Skalierung unter der Flagge von Vivaris als JUMA Recharge+ erfolgen.

Die food42morrow GmbH wurde 2022 in Frankfurt am Main mit dem Ziel gegründet, Marktlücken im Bereich Functional Food durch wissenschaftlich fundierte und trendorientierte Konzepte zu schließen. Die Gründer Raoul Kammann, Max Kammann und Carlos Lopez Granado entwickelten mit JUMA eine Antwort auf die steigende Nachfrage nach natürlichen Wachmachern.

Das Kernprodukt RECHARGE+ ist ein teebasierter Hydration Drink, der Elektrolyte, Vitamine und natürliches Koffein (u. a. aus Guayusa) kombiniert. Der Fokus liegt hierbei auf einer Funktionalität ohne Zuckerzusatz, die speziell auf die Bedürfnisse einer urbanen, aktiven Zielgruppe zugeschnitten ist. Bereits 2025 konnte das Start-up die Marktfähigkeit durch erste Listungen im deutschen Lebensmitteleinzelhandel (LEH) nachweisen.

Packaging-Innovation als strategischer Hebel

Ein wesentliches Alleinstellungsmerkmal, das den Exit maßgeblich begünstigt haben dürfte, ist das innovative Gebinde. food42morrow brachte als erstes Unternehmen in Deutschland eine wiederverschließbare Aluminiumflasche mit Schraubverschluss in dieser Kategorie auf den Markt. Diese Verpackung kombiniert die hohe Recyclingquote von Aluminium mit der Flexibilität einer Flasche. Für etablierte Konzerne wie die Berentzen-Gruppe stellt eine solche bereits validierte „Hardware-Innovation“ einen hohen Wert dar, da sie das Risiko bei der Markteinführung neuer Kategorien senkt.

Einordnung: Die „Evolve 2030“-Strategie

Der Zukauf durch die Berentzen-Gruppe ist kein Zufall, sondern Teil einer breiteren Branchenbewegung. Mit der Strategie BERENTZEN EVOLVE 2030 reagiert der Konzern auf den rückläufigen Spirituosenkonsum und investiert massiv in das Segment der alkoholfreien Getränke (AfG). JUMA fungiert hierbei als Portfolio-Ergänzung im margenstarken Premium-Bereich der funktionalen Drinks. Ähnliche Strategien verfolgten zuletzt auch Akteure wie Eckes-Granini oder die Paulaner-Gruppe bei der Integration agiler Innovationsmarken.

Key Learnings für Gründer*innen

Aus dem Case food42morrow lassen sich drei zentrale Erkenntnisse für die Skalierung von Konsumgüter-Start-ups ableiten:

- USP durch Packaging: In einem gesättigten Markt reicht ein guter Inhalt oft nicht aus. Eine technologische oder funktionale Innovation bei der Verpackung kann der entscheidende Türöffner für den LEH und für Akquisitionsgespräche sein.

- Validierung vor Skalierung: Der Exit erfolgte erst, nachdem die Marktfähigkeit (Proof of Market) durch erste Listungen 2025 bewiesen war. Große Player kaufen bevorzugt Marken, die ihre „Kinderkrankheiten“ bereits überwunden haben.

- Positionierung als „Brückenbauer“: food42morrow hat sich erfolgreich als Bindeglied zwischen Start-up-Agilität und industrieller Skalierung positioniert. Dies ermöglicht es den Gründern, sich auf ihre Kernkompetenz – die Produktentwicklung – zu konzentrieren, während die massive Distribution durch die Strukturen eines Konzerns erfolgt.

Was kommt nach JUMA?

Mit der Übergabe der Marke an Vivaris stellt food42morrow seine Kompetenz als Innovationstaktgeber unter Beweis. Bleibt die spannende Frage, welche Trends das Frankfurter Team als Nächstes identifiziert.

meinhaus.digital sammelt eine Mio. Euro für die Sanierungswende ein

Ein „KI-Architekt“, der Renovierungen von Bestandsimmobilien deutlich günstiger und schneller machen soll: Das PropTech meinhaus.digital hat eine Pre-Seed-Finanzierungsrunde in Höhe von einer Million Euro abgeschlossen.

Das von Leonie Dowling, Carolin Krebber und Ina Schröder gegründete PropTech-Start-up meinhaus.digital GmbH mit Sitz in Schwäbisch Gmünd und München hat frisches Kapital in Höhe von einer Million Euro eingesammelt. Angesichts eines Marktes für energetische Gebäudesanierung in Deutschland, in den laut dem Deutschen Institut für Wirtschaftsforschung jährlich über 70 Milliarden Euro fließen, verdeutlicht diese Investition das hohe Interesse an digitalen Lösungen für die Bau- und Immobilienbranche. Getragen wird die Finanzierungsrunde von der L-Bank Baden-Württemberg sowie Business Angels aus Stuttgart und München, zu denen auch der Start-up-Investor Martin Giese gehört.

Der Blick ins Register: Neustart statt Neugründung

Hinter meinhaus.digital stehen die drei Gründerinnen Leonie Dowling, Carolin Krebber und Ina Schröder, wobei Dowling und Krebber als Co-CEOs agieren. Ein Blick ins Handelsregister zeigt: Die rechtliche Keimzelle des Start-ups wurde von Dowling bereits 2021 unter dem Namen Palasts GmbH gegründet. Das Jahr 2025 markiert hingegen den operativen Neustart unter dem heutigen Namen meinhaus.digital sowie die Formierung des aktuellen Gründerinnen-Trios. Ungeachtet dieser Vorgeschichte ist das personelle Wachstum beachtlich. Seit 2025 wuchs das Team von drei auf zwölf Mitarbeiterinnen und Mitarbeiter an. Bis Ende 2026 soll die Belegschaft auf rund 30 Personen aufgestockt werden, wobei der Fokus stark auf den Bereichen Technologie, Vertrieb und Marketing liegt.

KI statt Architekt: Kampfpreis und OBI-Deal

Das Start-up positioniert sich als digitaler Planer für Umbau- und Sanierungsprojekte bei Bestandsimmobilien. Die Plattform kombiniert dafür eine KI-gestützte Software mit dem Fachwissen von echten Architektinnen, Architekten sowie der Energieberatung. Das Ziel ist es, Hauskäufer*innen und Eigentümer*innen eine transparente Maßnahmen-, Kosten- und Finanzierungsplanung aus einer Hand zu liefern. Das Versprechen der Gründerinnen, Planungsleistungen bis zu 70 Prozent günstiger und bis zu zehnmal schneller als klassische Architektenleistungen anzubieten, ist dabei eine klare Kampfansage an die traditionelle Zunft.

Um dieses Modell rasant in den Markt zu drücken, nutzt meinhaus.digital strategische B2B2C-Partnerschaften. Eine Kooperation mit der Baumarktkette OBI läuft bereits und soll die digitale Maßnahmenplanung mit der Umsetzungskompetenz des Marktes verknüpfen. Weitere Pilotprojekte mit Branchengrößen wie Check24, Wüstenrot und Schwäbisch Hall stehen kurz vor dem Roll-out. Damit soll der Kund*innenstamm von aktuell über 100 auf mehr als 4.000 skalieren, um langfristig den Umsatz bis 2027 zu verzehnfachen. Der Bedarf ist da, denn die reale Sanierungsquote hinkt den Klimazielen massiv hinterher, da Planungsleistungen für viele schlichtweg zu aufwendig und zu teuer sind.

Reality-Check: Kommt die Software gegen den Altbau an?

Doch die Vision vom digitalen Architekten muss sich in der harten Realität des deutschen Altbaubestandes erst noch dauerhaft beweisen. Jede Bestandsimmobilie bringt individuelle statische, bauphysikalische und rechtliche Tücken mit sich. Ob die hybride Lösung aus Software und menschlicher Expertise die Nuancen eines verbauten Altbaus lückenlos und fehlerfrei erfassen kann, muss sich in der Praxis zeigen. Auch das Versprechen, signifikant günstiger zu sein, birgt Risiken in puncto Profitabilität. Dies erfordert radikal standardisierte Prozesse im Hintergrund, um als VC-finanziertes Start-up dauerhaft profitable Margen zu erwirtschaften.

Hinzu kommt eine massive Konkurrenz. Der PropTech-Sektor ist heiß umkämpft und gut finanziert. Schwergewichte wie das Berliner Start-up Enter oder Fuchs & Eule positionieren sich bereits extrem stark und mit massivem Werbedruck im Bereich der digitalen Energieberatung, 3D-Modellierung und Fördermittelbeantragung. Das junge Team aus München und Schwäbisch Gmünd muss nun beweisen, dass die architektonische Tiefe ihres Produkts einen echten Burggraben gegenüber der reinen Energieberatung der Wettbewerber bildet.

Fazit: Smartes Playbook, harter Stresstest

Für die Start-up-Community liefert meinhaus.digital ein brillantes Playbook in Sachen Go-to-Market-Strategie. Anstatt das frische Kapital in teures, umkämpftes Endkund*innen-Marketing zu verbrennen, setzt das Team konsequent auf den B2B2C-Kanal. Die Integration in die etablierte Customer Journey von Playern wie OBI oder großen Bausparkassen ist ein top Hebel, um die Kund*innenakquisitionskosten drastisch zu senken und sich Vertrauen bei den Endkund*innen zu leihen.

Gründer*in der Woche: SpeakerMatching.com – Disruption auf der Bühne

Die Eventbranche wächst, doch die Suche nach den passenden Köpfen für die Bühne gleicht oft noch einem analogen Kraftakt. Mit der Plattform SpeakerMatching.com will eine erfahrene Seriengründerin den Spieß nun umdrehen. Es ist ein klassisches Plattform-Play ohne die üblichen Vermittlungsprovisionen – doch kann sich das Modell gegen etablierte Branchengrößen durchsetzen? Wir haben die Gründerin Henriette Hochstein-Frädrich befragt.

Hinter SpeakerMatching.com, im November 2025 als B2B-Marktplatz gelauncht, steht Henriette Hochstein-Frädrich. Sie kennt den Schmerz der Branche nicht nur vom Hörensagen. „Ich kenne den Markt nicht nur als Plattformunternehmerin, sondern auch aus zwei weiteren sehr praktischen Perspektiven: Seit vielen Jahren stehe ich selbst als Speakerin und Moderatorin auf Bühnen, und zugleich habe ich eigene Eventformate und Veranstaltungsreihen im Bereich modernes Female Empowerment konzipiert und umgesetzt“, erinnert sich die Gründerin.

„Gerade als Veranstalterin wurde mir immer wieder bewusst, wie zeitaufwendig, intransparent und teilweise zufallsgetrieben die Suche nach passenden Rednerinnen sein kann“, bringt sie das Kernproblem auf den Punkt. Gleichzeitig habe sie beobachtet, wie sich der Markt zunehmend professionalisiere: „Es gibt mehr Expertinnen, mehr Themen, mehr Formate, aber bislang keine wirklich zeitgemäße digitale Infrastruktur, die Angebot und Nachfrage effizient zusammenführt.“

Dass sie diese Infrastruktur bauen kann, hat sie in der Vergangenheit bewiesen: 2009 gründete sie Pharmatching.com, baute es zur Branchengröße auf und verkaufte es 2017. „Aus meinen früheren Plattformgründungen habe ich vor allem drei zentrale Lektionen mitgenommen: Erfolgreiche Marktplätze lösen ein echtes, konkretes Problem. Vertrauen und Qualität sind im B2B-Umfeld entscheidend. Und nicht zuletzt spielt Timing eine größere Rolle, als viele denken“, betont Hochstein-Frädrich.

Rollentausch statt Kaltakquise

Das Timing sei deshalb ideal, weil Veranstaltende heute Plattformlogiken und Self-Service-Modelle erwarten, wie sie sie aus anderen B2B-Märkten längst kennen. Der Kern von SpeakerMatching.com liegt in der Umkehrung des klassischen Buchungsprozesses. Veranstaltende formulieren ihr Gesuch kostenfrei auf der Plattform, woraufhin sich Speaker*innen direkt bewerben können. Das Start-up finanziert sich stattdessen über Abonnements für die Rednerinnen.

„Uns war von Anfang an wichtig, ein sehr niedrigschwelliges und zugleich faires Preismodell für Speaker*innen zu schaffen“, rechnet die Geschäftsführerin vor. Die monatlichen Mitgliedschaften liegen zwischen rund 59 und 89 Euro. „Wenn über die Plattform ein einzelner Auftrag im mittleren vierstelligen Bereich zustande kommt, hat sich die Investition für viele Redner*innen bereits mehrfach amortisiert.“ Sie stellt aber auch klar: „SpeakerMatching.com ist ein Marktplatz, kein Management- oder Vermittlungsvertrag.“

Doch wie verhindert man eine Flut an unpassenden Bewerbungen? „Die Sorge vor einer unüberschaubaren Bewerbungsflut ist absolut nachvollziehbar, gerade bei offenen Plattformmodellen“, räumt die Gründerin ein. Da Veranstaltende jedoch Parameter wie Budget, Zielgruppe oder Sprache sehr konkret vorgeben, entstehe eine starke Vorfilterung. „Unsere bisherigen Erfahrungen aus den ersten Monaten zeigen sehr deutlich: Unpassende ‚Blindbewerbungen‘ sind die absolute Ausnahme“, versichert Hochstein-Frädrich. Zwar sollen perspektivisch KI-basierte Funktionen eine stärkere Rolle spielen, doch die Vision bleibt menschlich: „Unser Ziel ist daher kein vollständig automatisiertes ‚Black-Box-Matching‘, sondern eine intelligente Plattform, die Entscheidungsprozesse vereinfacht und die Qualität der Interaktionen erhöht.“

Um das Problem des Bypassings – also den Abschluss an der Plattform vorbei – zu umgehen, werden Event-Gesuche zunächst anonymisiert veröffentlicht. „Erst wenn sie passende Bewerbungen erhalten und aktiv in den Austausch gehen möchten, geben sie ihre Identität preis“, erklärt die Gründerin den Prozess. „Wenn Speaker*innen über SpeakerMatching.com kontinuierlich relevante Anfragen erhalten und Veranstaltende effizient passende Expertinnen finden, entsteht eine stabile Win-Win-Dynamik. Genau darauf ist das Modell ausgelegt.“

Markt, Wettbewerb und organisches Wachstum

Der Markt wächst kontinuierlich, wird aber von großen Redneragenturen wie Speakers Excellence oder Premium Speakers dominiert. Diese arbeiten stark kuratiert und rufen oft hohe Vermittlungsprovisionen auf. Um in diesem zweiseitigen Markt das klassische Henne-Ei-Problem zu überwinden, verzichtet die Plattform auf der Veranstaltendenseite auf Gebühren.

Finanziert ist das Vorhaben bisher weitgehend aus eigener Kraft. „Aus meinen früheren Gründungen weiß ich, wie wichtig es gerade in der frühen Phase eines zweiseitigen Marktplatzes ist, Produkt, Zielgruppe und Marktmechanik zunächst sehr präzise zu verstehen und organisch zu entwickeln“, lautet ihr Credo. „Plattformmodelle brauchen Zeit, Vertrauen und kritische Masse, das lässt sich nicht ausschließlich mit Kapital ‚beschleunigen‘, sondern vor allem durch konsequenten Nutzen für beide Marktseiten“.