Aktuelle Events

KI-Start-up Prior Labs erhält 9 Mio.-Euro-Pre-Seed-Finanzierung

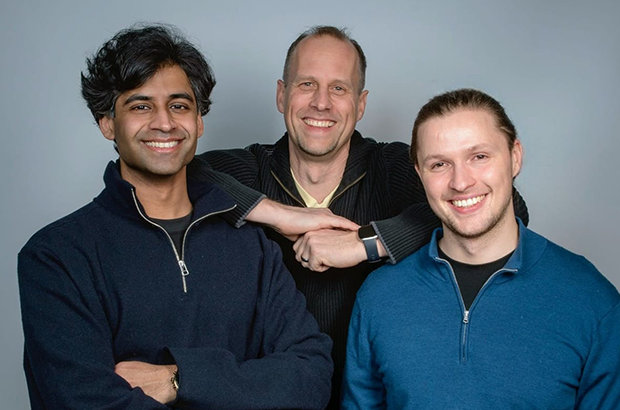

Das 2024 von Frank Hutter, Noah Hollmann und Sauraj Gambhir gegründete Freiburger KI-Start-up Prior Labs hat ein neues KI-Modell (TabPFN) für tabellarische Daten entwickelt, um das bisher ungenutzte Potenzial von Tabellen- und Datenbankanalysen freizusetzen.

Sogenannte strukturierte Daten in Tabellen und Datenbanken finden sich überall – in klinischen Studien, im Finanzsektor, bei Umweltmessungen oder auch in der Fertigung. Doch während generative KI für Text und Bilder bisher das Gespräch dominieren, spielten Tabellen kaum eine Rolle. Der Grund dafür: Die Daten sind unübersichtlich, vielfältig und stark kontextbezogen. In der Regel nutzen Unternehmen daher nach wie vor veraltete Tools oder sind für jede Aufgabe auf teure, maßgeschneiderte ML-Modelle angewiesen.

Tabellen-KI für besseren Umgang mit Unternehmensdaten

Das 2024 von Frank Hutter, Noah Hollmann und Sauraj Gambhir mit Unterstützung von Bernhard Schölkopf und Alex Diehl gegründete Prior Labs steht für einen Paradigmenwechsel: Ihr TabPFN-Modell bietet eine universelle Lösung, um tabellarische Daten zu analysieren. Es wurde auf 130 Millionen synthetischen Datensätzen trainiert und kann sofort Muster in jedem Datensatz verstehen und ableiten, ohne dass ein aufgabenspezifisches Training erforderlich ist. Als Basismodell kann es außerdem mit unternehmenseigenen Daten optimiert werden, sodass es kontinuierlich genauer wird und sich besser an reale Herausforderungen anpasst.

TabPFN: Präziser, schneller, günstiger

Zudem ist TabPFN präziser als andere moderne Modelle: Laut Aussagen des Unternehmens übertraf es bei kleinen tabellarischen Daten übertraf es diese in über 96 Prozent der breit gefächerten Vorhersageprobleme. Dazu benötigt TabPFN nur 50 Prozent der Daten, um dieselbe Genauigkeit zu erreichen, wie das nächstbeste Modell mit allen Daten. Zudem benötigt es nur 2,8 Sekunden, um eine bessere Leistung zu erzielen als die besten Modelle in mehr als 4 Stunden. Es ist einfach zu bedienen und lässt sich mit nur wenigen Zeilen Code auf jeden Datensatz anwenden.

TabPFN kann Branchen wie Handel, Finanzwesen oder Bereiche der Geschäftsanalyse deutlich rentabler machen. Denn es liefert schnellere und genauere Vorhersagen – die Grundlage, um wichtige Entscheidungen treffen zu können. Auch Branchen mit beschränkter Datenverfügbarkeit wie dem Gesundheitswesen, der Medizin und der Klimaforschung, in denen es oft schwierig oder teuer ist, Daten zu erfassen, profitieren von TabPFNs Dateneffizienz. Das Modell kann auch für Zeitreihenprognosen verwendet werden und belegt derzeit den ersten Platz im branchenüblichen GIFT-Eval-Benchmark, vor dem beliebten Chronos-Modell von Amazon oder Google’s Modellen.

Die aktuelle Finanzierungsrunde wird von Balderton Capital angeführt; ebenfalls beteiligt sind XTX Ventures, die Hector Foundation des SAP-Gründers Hans Werner-Hector, Atlantic Labs und Galion.exe. Ebenfalls investierten prominente KI-Angel-Investor*innen wie Thomas Wolf (Gründer und CSO von Hugging Face), Peter Sarlin (Gründer und CEO von Silo AI), Guy Podjarny (Gründer von Snyk und Tessl), Robin Rombach (Gründer und CEO von Black Forest Labs), Ed Grefenstette (Director bei DeepMind), Chris Lynch (Gründungsinvestor Data Robot und CEO von AtScale), Ash Kulkarni (CEO von Elastic) sowie weitere Führungskräfte.

Mit dem frischen Kapital plant Prior Labs, die Produktentwicklung zu beschleunigen, das Team zu erweitern und sein revolutionäres Grundlagenmodell mehr Nutzer*innen zugänglich zu machen.

Verbesserte API für nahtlose Einbindung

Als weiteren Meilenstein bietet Prior Labs nun eine verbesserte API an. Sie ermöglicht Unternehmen, die Funktionen von TabPFN nahtlos zu integrieren. Weiterhin arbeitet das Freiburger Start-up daran, sein Basismodell noch schneller, genauer und effizienter zu machen. So unterstützt das neue Modell inzwischen Textmerkmale und kann mit eigenen Daten verbessert werden. Zudem lassen sich kontextbezogene Informationen über die Problemdomäne einbeziehen, was TabPFN noch genauer und benutzerfreundlicher macht.

Frank Hutter, Mitgründer und CEO von Prior Labs, kommentiert: „Die meisten kritischen Entscheidungen in der Welt stützen sich auf Tabellendaten. Doch die meisten Datenanalysetools sind veraltet, wirklich intelligente Tools fehlen bisher. Unser Basismodell bedeutet einen Quantensprung für Wissenschaft und Unternehmen und ihre wertvollsten Daten. Wir arbeiten an einer Zukunft, in der Tabellen mithilfe von KI genauso unkompliziert verarbeitet werden können, wie es bereits für Text und Bilder der Fall ist. Unser Modell liefert deutlich schneller genauere Vorhersagen als bisherige Ansätze und liefert größeren Nutzen aus kleineren Datensätzen.“

James Wise, Partner bei Balderton Capital, ergänzt: „Tabellarische Daten sind das Rückgrat von Wissenschaft und Wirtschaft. Aber der bisherige KI-Boom, der Daten wie Texte, Bilder oder Videos erfasst hat, wirkt sich bisher nur marginal auf tabellarische Daten aus. Der Durchbruch von Prior Labs setzt die Superkräfte des maschinellen Lernens nun auch für diesen Bereich frei – ohne dass alle ihre eigenen Modelle trainieren müssen. Wir freuen uns, dieses Spitzenteam dabei zu unterstützen, in ganzen Branchen den Wert von Tabellendaten zu erschließen.“

Diese Artikel könnten Sie auch interessieren:

DeepTech trifft Food-Safety: 2,6 Mio. Euro für NanoStruct

Food-Safety-Revolution? NanoStruct weist Bakterien in Stunden statt Tagen nach & holt 2,6 Mio. € Seed-Kapital. Wir machen den DeepTech-Check.

Frische Lebensmittel sind ein Wettlauf gegen die Zeit. Bislang dauert der Nachweis von gefährlichen Erregern wie Salmonellen oder Listerien oft mehrere Tage – ein erhebliches Risiko für verderbliche Waren. Das Würzburger Uni-Spin-off NanoStruct will diesen Engpass mit einer neuen Analyseplattform beheben und hat dafür nun eine Seed-Finanzierung in Höhe von 2,6 Millionen Euro eingesammelt. Doch wie tragfähig ist das DeepTech-Modell in der konservativen Lebensmittelindustrie wirklich?

Das Würzburger Startup NanoStruct tritt an, um die mikrobiologische Lebensmittelanalyse von Grund auf zu beschleunigen. Durch die Kombination von optischer Messtechnik, Nanotechnologie, Biotechnologie und maschineller Datenauswertung soll der Nachweis pathogener Bakterien von mehreren Tagen auf wenige Stunden schrumpfen.

Die aktuelle Seed-Runde über 2,6 Millionen Euro bringt namhafte Investoren an Bord: Angeführt wird die Runde vom High-Tech Gründerfonds (HTGF), Bayern Kapital und dem AUXXO Female Catalyst Fund. Ergänzt wird das Kapital durch drei Business Angels aus dem Netzwerk von BayStartUP.

Gold-Antennen statt Petrischalen

Im Kern basiert das Verfahren von NanoStruct auf der sogenannten Surface-enhanced Raman Spectroscopy (SERS). Die Sensoren nutzen dabei ultrapräzise Gold-Nanoantennen, um selbst geringste Mengen von Bakterien verlässlich zu identifizieren.

Interessant ist hierbei ein Blick auf die technologischen Versprechungen: Während das Startup in jüngsten Einreichungen für Branchenpreise (wie den AMA Innovationspreis 2025) noch explizit von einem "Drei-Minuten-Bakterientest" sprach, stapelt die aktuelle Pressemitteilung etwas tiefer und verspricht eine Verkürzung auf "wenige Stunden". Dies ist ein bekanntes Phänomen in der Bio-Sensorik: Während die reine optische Messung im Labor oft nur Minuten dauert, nimmt die komplexe Probenaufbereitung aus realen, unsauberen Lebensmittelmatrizen in der Praxis weiterhin Stunden in Anspruch. Dennoch: Ein Testergebnis noch am selben Tag ("Same-Day-Detection") bedeutet für Produzenten einen gewaltigen Fortschritt.

Aus dem Uni-Labor zum Millionen-Funding

Die Wurzeln des Unternehmens liegen in der Julius-Maximilians-Universität Würzburg, aus der NanoStruct 2021 ausgegründet wurde. Das Gründerteam vereint dabei interdisziplinäre Kompetenzen:

Dr. Henriette Maaß (CEO) verantwortet die Unternehmensstrategie. Sie führte das Startup bereits erfolgreich durch das EU-Förderprogramm "Women TechEU", welches von Frauen geführte Hochtechnologie-Startups unterstützt.

Enno Schatz (CTO) bringt als Experte für Nano-Optik und Sensorik das tiefe technologische Know-how ein.

Kai Leibfried (CFO) steuert die Finanzierung, Geschäftsentwicklung und die kaufmännischen Prozesse.

Der Weg zur Seed-Runde wurde unter anderem durch BayStartUP geebnet: Bereits 2021 gewann das Team das Finale des Businessplan-Wettbewerbs Nordbayern. Aus diesen ersten Berührungspunkten entwickelte sich laut Carsten Rudolph, Geschäftsführer von BayStartUP, das heutige Investorenkonsortium.

Markt, Geschäftsmodell und Wettbewerb – Eine Einordnung

Mit dem frischen Kapital plant NanoStruct nun die Industrialisierung der Technologie, erste Pilotprojekte mit Kunden sowie den Ausbau des Vertriebs. Langfristig sehen die Investoren das Potenzial der Plattform-Technologie auch in weiteren kritischen Bereichen wie der Wasserversorgung, der Medizintechnik oder der Diagnostik.

StartingUp ordnet das Vorhaben wie folgt ein:

Der Markt (Pro): Das wirtschaftliche Potenzial ist enorm. Erreger-Tests am selben Tag reduzieren Lebensmittelverschwendung drastisch, da verderbliche Waren nicht mehr tagelang in Quarantäne-Lagern auf ihre Freigabe warten müssen. Zudem lassen sich millionenschwere, rufschädigende Rückrufaktionen frühzeitig abwenden.

Markteintrittsbarrieren (Contra): Die Lebensmittelindustrie ist hochgradig konservativ und streng reguliert. Ein neues Testverfahren muss nicht nur schneller, sondern zu 100 Prozent fehlerfrei arbeiten. "False-Positives" (falscher Alarm) kosten die Industrie Geld, "False-Negatives" gefährden Menschenleben. Das Vertrauen der Industrie in etablierte Standardverfahren ist historisch gewachsen und tief verankert.

Hardware-Skalierung: Im Gegensatz zu reinen Software-Geschäftsmodellen muss NanoStruct die SERS-Sensoren auf Nanotechnologie-Basis wirtschaftlich in Masse herstellbar machen. Die Skalierung von DeepTech-Hardware verschlingt erfahrungsgemäß viel Zeit und hohe Folgeinvestitionen.

Der Wettbewerb: NanoStruct tritt gegen milliardenschwere Diagnostik-Konzerne und etablierte Verfahren wie PCR-Tests an. Der entscheidende USP von NanoStruct wird es sein, zu beweisen, dass die Sensoren in der rauen industriellen Praxis tatsächlich so robust, günstig und verlässlich sind, dass sie die immensen Wechselkosten für Großkunden rechtfertigen.

Fazit

NanoStruct bringt technologisch exzellente Voraussetzungen mit und hat sich mit dem HTGF, Bayern Kapital und AUXXO sehr starke, gut vernetzte Partner gesichert. Gelingt es dem Team nun, die Technologie aus dem Würzburger Labor erfolgreich in die industrielle Realität der Lebensmittelproduktion zu übertragen, könnte das Startup tatsächlich einen neuen Goldstandard in der mikrobiologischen Qualitätskontrolle etablieren. Die wichtigste Phase – der Beweis am Kunden – beginnt jetzt.

Wie das TechBio-Start-up mbiomics mit 30 Mio. Euro die Krebstherapie skalierbar machen will

Stuhltransplantationen haben gezeigt, dass das Darmmikrobiom ein mächtiger Hebel gegen Krebs sein kann – doch der Ansatz ist bisher kaum standardisierbar. Das Münchner Unternehmen mbiomics setzt auf künstliche Intelligenz und maßgeschneiderte Bakterien-Cocktails aus dem Labor. Mit dem Abschluss einer 30-Millionen-Euro-Serie-A-Runde rückt die klinische Phase näher. Ein genauer Blick auf das Geschäftsmodell, die Gründer*innen und einen hart umkämpften globalen Markt.

Wer heute von modernster Krebstherapie spricht, kommt am menschlichen Darm nicht mehr vorbei. Die wissenschaftliche Datenlage der letzten Jahre hat sich massiv verdichtet: Ob ein Patient auf revolutionäre Krebs-Immuntherapien (wie Immun-Checkpoint-Inhibitoren) anspricht, hängt maßgeblich von der individuellen Zusammensetzung seines Mikrobioms ab. Das Münchner TechBio-Unternehmen mbiomics hat sich genau dieses Zusammenspiel zur Mission gemacht und gab heute den dritten Abschluss seiner Serie-A-Finanzierungsrunde bekannt. Mit neu eingeworbenen 12 Millionen Euro wächst das Gesamtvolumen der Runde auf beachtliche 30 Millionen Euro.

Das Kapital, das unter anderem von erfahrenen Investoren wie den MIG Fonds und Bayern Kapital stammt, markiert für das 2020 gegründete Unternehmen einen entscheidenden Wendepunkt: den Übergang von der reinen Technologieplattform hin zur klinischen Anwendung am Menschen. Der führende Wirkstoffkandidat „MBX-116“ soll 2027 in einer Phase-1B-Studie an Patienten mit fortgeschrittenem schwarzen Hautkrebs (Melanom) getestet werden. Doch wie belastbar ist dieser Ansatz im Vergleich zum Wettbewerb?

Die Köpfe hinter der Vision

Aus der Taufe gehoben wurde mbiomics im Jahr 2020 von Dr. Laura Figulla, Dr. Johannes B. Wöhrstein und Dr. Markus Rinecker. Während die Mitgründer Figulla und Rinecker das Unternehmen in der frühen Phase prägten, wird die nun anstehende Skalierung und klinische Validierung von einem spezialisierten Leadership-Trio gesteuert:

- Dr. Johannes B. Wöhrstein (CEO & Mitgründer): Als technologischer Kopf und Geschäftsführer verantwortet er die firmeneigene Plattform. Seine Expertise in hochauflösender Analytik ist das Fundament, um komplexe mikrobielle Netzwerke mithilfe von maschinellem Lernen (KI/ML) überhaupt erst zu kartieren.

-

Kristin Torre Vinuesa (CFO): Als Chief Financial Officer verantwortet sie die finanziellen Geschicke des Unternehmens. Ihre Rolle ist entscheidend, um die neu eingeworbenen 30 Millionen Euro strategisch einzusetzen, den naturgemäß hohen Kapitalbedarf der anstehenden klinischen Studien („Cash Burn“) effizient zu steuern und das finanzielle Fundament für zukünftige Runden zu sichern.

- Dr. Christopher Weidenmaier (CSO): Der erfahrene Mikrobiologe (zuvor unter anderem beim US-Konkurrenten Finch Therapeutics) komplettiert das heutige Führungstrio. Als Chief Scientific Officer leitet er die präklinische Forschung und treibt das rationale Design der komplexen Bakterien-Konsortien maßgeblich voran.

Das Problem: Die Unberechenbarkeit der Natur

Um das Geschäftsmodell zu verstehen, muss man den Status quo betrachten. In der Onkologie wird aktuell intensiv mit Stuhltransplantationen (Fecal Microbiota Transplants, FMT) experimentiert. Dabei wird das Mikrobiom von Patient*innen, die hervorragend auf Krebsmedikamente ansprechen, auf „Non-Responder“ übertragen. Die Erfolge sind bemerkenswert, doch das Verfahren hat einen massiven Haken: Stuhl ist ein hochvariables Naturprodukt. Er ist schwer zu standardisieren, birgt Infektionsrisiken und lässt sich nicht als skalierbares Pharma-Produkt im industriellen Maßstab herstellen.

Hier setzt mbiomics mit sogenannten Live Biotherapeutic Products (LBPs) an. Statt auf ungefilterte Spender*innen-Transplantate zu setzen, identifiziert das Team mittels KI genau jene Bakterienstämme, die für den therapeutischen Effekt verantwortlich sind. Diese werden dann im Labor nach pharmazeutischen GMP-Standards gezüchtet und als orale Kapsel verabreicht. Es ist der Versuch, die „Blackbox“ Darm in ein berechenbares, patentierbares Medikament zu verwandeln.

Wo liegen die Risiken?

Für Beobachter*innen der Start-up-Szene bleibt das Vorhaben trotz der Millionen-Finanzierung eine Hochrisiko-Wette. Ein TechBio-Start-up in diesem Stadium hat einen enormen „Cash Burn“. Die 30 Millionen Euro sind ein starkes Fundament, doch die klinische Entwicklung in der Onkologie ist ein Langstreckenlauf, der oft dreistellige Millionenbeträge verschlingt.

Zudem ist das Geschäftsmodell hochgradig binär: Die für 2027 geplante Studie muss erst beweisen, dass die im Labor designten Bakterien-Konsortien im komplexen menschlichen Ökosystem tatsächlich die erhoffte Wirkung zeigen. Ein Scheitern des Leitkandidaten MBX-116 könnte das gesamte Vertrauen in die Plattform erschüttern. Zudem ist die Herstellung lebender Bakterien in absolut reproduzierbarer Qualität eine enorme logistische und biotechnologische Herausforderung, an der bereits andere Pioniere der Branche hängen geblieben sind.

Der Markt: Ein globales Rennen

Mbiomics ist nicht allein auf diesem Feld. Das Unternehmen muss sich gegen hochkapitalisierte internationale Konkurrent*innen behaupten:

- MaaT Pharma (Frankreich): Die Franzosen sind klinisch bereits weiter fortgeschritten und setzen auf „Full-Ecosystem“-Produkte aus gepoolten Spenderproben. Mbiomics muss beweisen, dass ihr synthetischer Präzisions-Ansatz dem natürlichen Mix überlegen ist.

- Vedanta Biosciences (USA): Ein US-Schwergewicht, das ebenfalls definierte Bakterienkonsortien entwickelt und bereits über ein breites Netzwerk an Kooperationen mit der Big-Pharma-Industrie verfügt.

Unsere Einordnung

Für das deutsche Ökosystem ist der Erfolg von mbiomics ein Leuchtturm-Signal. Dass Investoren wie MIG – die bereits bei BioNTech ein frühes Gespür bewiesen – hier massiv nachlegen, unterstreicht die Qualität des Standorts München.

Mbiomics wählt den schwierigen, aber potenziell nachhaltigeren Weg. Statt auf die bloße Kopie der Natur zu setzen, versucht das Team, das Mikrobiom durch Daten beherrschbar zu machen. Gelingt der klinische Wirksamkeitsnachweis ab 2027, könnte das Start-up nicht nur die Onkologie verändern, sondern auch Blaupausen für die Behandlung von Autoimmun- und neurodegenerativen Erkrankungen liefern. Der Weg bis dahin bleibt jedoch teuer und wissenschaftlich riskant.

Vom Notfallknopf zum KI-Begleiter: Patronus sammelt 11 Mio. Euro ein

Das 2020 von Ben Staudt und Tim Wagner gegründete Berliner Start-up Patronus sichert sich eine weitere Mio.-Finanzierungsspritze für seinen digitalen (Notruf-)Assistenten im Smartwatch-Format. Doch im stark umkämpften Senior*innen-Tech-Markt reicht ein schickes Design allein nicht mehr aus. Ein Blick hinter die Kulissen von Geschäftsmodell, Historie und wachsendem Wettbewerb.

Die Idee zu Patronus entstand aus einem klassischen Alltagsproblem, das viele Familien kennen: Gründer Ben Staudt erlebte bei seiner eigenen Großmutter, dass der traditionelle, klobige Hausnotrufknopf statt um den Hals zu hängen, lediglich als „Nachttischdekoration“ fungierte. Gemeinsam mit Mitgründer Tim Wagner rief er daraufhin im Jahr 2020 das Unternehmen in Berlin ins Leben. Vor der Veröffentlichung ihres ersten Produkts im Jahr 2021 führte das Team nach eigenen Angaben über tausend Gespräche mit potenziellen Nutzer*innen. Die zentrale Erkenntnis: Die Ablehnung herkömmlicher Notrufsysteme ist weniger technischer Natur, sondern vielmehr ein Problem der Würde und Stigmatisierung.

Mittlerweile ist das Team auf 70 Mitarbeitende angewachsen. Nachdem das Start-up in der Vergangenheit bereits eine beachtliche 27-Millionen-Euro-Runde abschließen konnte, fließen nun weitere 11 Millionen Euro Wachstumskapital in das Unternehmen. Bei dieser Runde wird das Konsortium von 3TS Capital Partners angeführt. Begleitet wird die Finanzierung von Grazia Equity sowie Bestandsinvestoren wie Singular, Burda Principal Investments, Adjacent, NAP und UVC Partners.

Das Produkt: Hohe Akzeptanz trifft auf KI-Visionen

Das Kernprodukt von Patronus ist eine Smartwatch, die sich optisch bewusst von klassischer Medizintechnik abhebt, verschiedene Farben bietet und wie eine herkömmliche Armbanduhr wirkt. Ausgestattet mit einer integrierten SIM-Karte stellt sie im Notfall auf Knopfdruck eine sofortige Verbindung zu einer hauseigenen, mit Fachpersonal besetzten 24/7-Notrufzentrale her.

Der nutzer*innenzentrierte Ansatz zeigt laut Unternehmenszahlen deutliche Wirkung:

- Während klassische Hausnotrufgeräte laut Studien nur von 14 Prozent der Nutzer*innen durchgehend getragen werden.

- Liegt die tägliche Tragequote der Patronus-Uhr bei 85 Prozent.

- Mittlerweile verzeichnet das Start-up 25.000 aktive Kund*innen.

- Die hauseigene Zentrale hat für diese Nutzer*innen bereits mehr als eine halbe Million Notrufe beantwortet.

- Parallel dazu verbindet eine eigens entwickelte App 50.000 Angehörige mit den Senior*innen, um deren Status – wie den Standort oder ob die Uhr getragen wird – im Blick zu behalten.

Das frische Kapital fließt nun in den weiteren Ausbau der Marktführerschaft im mobilen Notrufsegment sowie in einen neuen Produktbereich: einen KI-Begleiter. Dieser soll als digitaler Assistent direkt am Handgelenk über die Patronus Uhr verfügbar sein. Da 12 Prozent der über 75-Jährigen in Deutschland an einem durchschnittlichen Tag kein einziges persönliches Gespräch führen, soll der Assistent dem Gefühl der Einsamkeit in stillen Stunden entgegenwirken.

Geschäftsmodell, Markt & Wettbewerb

So glänzend die Zahlen der Pressemitteilung wirken, verlangt das Geschäftsmodell im dynamischen AgeTech-Sektor eine differenzierte Betrachtung:

Der demografische Rückenwind: Der Bedarf an digitalen Lösungen für ältere Menschen wächst rasant. In Deutschland leben heute 9,6 Millionen Menschen im Alter von über 75 Jahren, in ganz Europa sind es 47,4 Millionen. Gleichzeitig nimmt die Zahl der pflegenden Angehörigen ab. Ein immer größerer Anteil will allein leben. Laut Destatis leben in Deutschland bereits 43 Prozent der Menschen über 75 Jahre allein.

Abo-Modell und Kassen-Abhängigkeit: Patronus refinanziert sich maßgeblich über ein Abo-Modell. Ein wesentlicher Wachstumstreiber ist dabei der deutsche Gesundheitsmarkt: Bei Vorliegen eines Pflegegrads kann die Pflegekasse die monatlichen Nutzungsgebühren (die Software, SIM-Karte und Leitstelle abdecken) stark bezuschussen. Ohne diese staatlichen Subventionen hätten viele Senioren Schwierigkeiten, die fortlaufenden Service-Kosten zu tragen. Diese Abhängigkeit von gesundheitspolitischen Rahmenbedingungen bleibt ein strukturelles Risiko.

Der harte Hardware-Wettbewerb: Patronus positioniert sich als digitaler Marktführer im mobilen Notrufsegment in Deutschland. Doch die Konkurrenz holt auf. Dedizierte Senior*innen-Smartwatches anderer Anbieter*innen bieten ebenfalls moderne Designs, SIM-Karten, Notruf-Sprachverbindungen und teils automatische Sturzerkennungen an. Zudem dringen Tech-Giganten tief in den Markt ein: Apple Watches verfügen längst über präzise Sturzerkennungen und EKG-Funktionen und werden zunehmend von technikaffinen "Best Agern" adaptiert. Der langfristige Burggraben von Patronus muss daher zwingend in der nahtlosen, stark vereinfachten Software-Integration und der menschlichen Notrufzentrale liegen – die Hardware allein ist auf Dauer austauschbar.

Das ethische Dilemma der KI: Einsamkeit unter älteren Menschen ist ein anerkanntes Gesundheitsrisiko, das die kognitive Leistungsfähigkeit beeinflussen, das Demenzrisiko erhöhen und die Lebenserwartung verkürzen kann. Die Lösung von Patronus, diesem Problem mit einem KI-Begleiter zu begegnen, ist innovativ, aber ethisch sensibel. Altersforscher warnen davor, dass "künstliche" Gespräche den Drang nach echten sozialen Interaktionen mindern könnten. Dass Patronus selbst betont, der KI-Begleiter solle menschliche Nähe nicht ersetzen, sondern nur eine Antwort für Stunden bieten, in denen niemand da ist, ist ein wichtiger Disclaimer. Dennoch muss das Unternehmen in der Praxis beweisen, dass die KI im sensiblen Pflegeumfeld echte Empathie simulieren kann, ohne die Nutzer*innen zu verwirren.

Unser Fazit

Patronus zeigt, wie man durch konsequentes User-Centric-Design einen verstaubten Markt aufbricht und stigmatisierte Produkte salonfähig macht. Die neuen 11 Millionen Euro geben dem Start-up den nötigen Spielraum für technologische Innovationen. Um die hohe Bewertung nachhaltig zu rechtfertigen, muss Patronus künftig jedoch beweisen, dass der Vorstoß in die künstliche Intelligenz ethisch sauber umgesetzt wird und man dem zunehmenden Hardware-Preisdruck der Wettbewerber*innen standhalten kann.

Omegga sichert 10 Mio. EUR gegen das Kükentöten

Das 2020 gegründete Münchner Start-up Omegga sichert sich Seed-Kapital für seine optische KI-Spektroskopie. Unsere Marktanalyse.

Omegga wurde 2020 von Katharina Hesseler, Till Nöllgen und Paul Günther gegründet. Zum erweiterten Gründer:innenkreis gehören zudem Moritz Eder, Kyle Hiroyasu und Clara Kaufhold. Das Team bündelt Expertise in den Bereichen KI, Optik und industrielle Systeme. In den vergangenen Jahren entwickelte das Team seine Technologie kontinuierlich vom Prototypen zum Industriestandard weiter und konnte sich bereits 2023 eine Pre-Seed-Finanzierung sowie 2024 Fördermittel des European Innovation Council (EIC) sichern.

CEO und Mitgründerin Katharina Hesseler sieht in dem Einstieg der neuen Partner, die „tiefes technologisches Verständnis mitbringen“, ein „starkes Signal für das enorme Potenzial unseres Ansatzes, einen neuen Standard in der Industrie zu setzen“. Das frische Kapital soll in den gezielten Ausbau des Teams und die kommerzielle Skalierung der Technologie fließen.

Das Problem und die technologische Lösung

Der erste und bereits kommerziell verfügbare Use Case von Omegga widmet sich einem der massivsten ethischen Probleme der modernen Landwirtschaft. Jährlich werden weltweit Milliarden männlicher Küken direkt nach dem Schlüpfen getötet, da sie weder Eier legen noch für die Masthaltung wirtschaftlich nutzbar sind.

Mit der sogenannten spektralen Intelligenz – der Kombination aus KI und Spektroskopie – will Omegga das Unsichtbare sichtbar machen. Im Gegensatz zu vielen Marktbegleitern wählt Omegga einen rein optischen, nicht-invasiven Weg. Durch spezielle Kameras und Lichtfrequenzen werden die Eier im Brutkasten gescannt. Laut eigenen Angaben bietet das Start-up damit die früheste am Markt kommerziell verfügbare Technologie, um das Geschlecht noch vor dem Schlüpfen zu bestimmen. Das System ist bereits bei Kund*innen im laufenden industriellen Produktionsbetrieb im Einsatz.

Markt, Wettbewerb & regulatorischer Druck

Der Markt für das „In-Ovo-Sexing“ wächst rasant, primär getrieben durch den Gesetzgeber. In Deutschland ist das Kükentöten seit 2022 gesetzlich verboten, Frankreich zog nach, und ein EU-weites Verbot wird debattiert. Der Zwang zur Adaption in den Brütereien ist entsprechend hoch.

Omegga tritt in ein Feld ein, das bereits von finanzstarken Konkurrenten besetzt ist:

SELEGGT: Gilt als früher Pionier auf dem Markt. Das Unternehmen nutzt hormonelle Tests am 9. Bruttag, wofür das Ei mittels eines Lasers winzig klein geöffnet werden muss (minimal-invasiv).

In Ovo: Das niederländische Unternehmen setzt auf Flüssigkeitsanalysen mittels Massenspektrometrie am 9. Bruttag und sicherte sich erst kürzlich ein 42-Millionen-Euro-Darlehen der Europäischen Investitionsbank (EIB).

Agri Advanced Technologies (AAT): Die Tochter der EW Group dominiert weite Teile des Marktes mit hyperspektraler Bildgebung, die primär für braune Eier zwischen dem 11. und 13. Tag genutzt wird.

Der entscheidende Vorteil von Omegga: Die Methode kommt völlig ohne Verbrauchsmaterialien wie Chemikalien oder feine Nadeln aus. Da die Eier bei der rein optischen Methode unversehrt bleiben, entfällt das systembedingte Kontaminationsrisiko, das bei invasiven Verfahren entstehen kann.

Unsere Einordnung

Trotz der vielversprechenden Technologie steht Omegga vor Herausforderungen:

Hardware-Skalierung in rauen Umgebungen: Die Systeme müssen in den feuchten, warmen und staubigen Inkubatoren industrieller Brütereien über Jahre hinweg wartungsarm laufen. Hier muss das Start-up beweisen, dass sich die Technologie reibungslos in den globalen Massenbetrieb integrieren lässt.

Der regulatorische „Faktor Zeit“: Rein optische Modelle benötigen oft bis zum 12. Tag für eine verlässliche Auswertung. Sollte die Politik die „Tag 6“-Frist künftig strikt durchsetzen, müssen die KI-Modelle von Omegga beweisen, dass sie derart früh hochpräzise Ergebnisse liefern.

Die Plattform-Vision – Fluch oder Segen?

Omegga positioniert seine Lösung ausdrücklich als Plattformtechnologie für die Landwirtschaft, Lebensmittelproduktion und industrielle Qualitätskontrolle. Wie stark dieses Narrativ bei den Geldgebern verfängt, zeigen die Statements zur aktuellen Runde: Laut Christian Knott (Capnamic) entsteht hier eine Technologie „mit dem Potenzial, gleich mehrere Industrien grundlegend zu verändern“. Auch Mason Sinclair (IQ Capital) lobt die Schaffung einer „Plattform für die nicht-invasive und branchenübergreifende Materialanalyse“.

Dass solche Visionen bei Investor*innen beliebt sind, da sie den adressierbaren Markt massiv vergrößern, ist nachvollziehbar. Für ein 17-köpfiges Start-up birgt die gleichzeitige Erschließung neuer Industriezweige jedoch die Gefahr einer operativen Verzettelung. Der Fokus muss zunächst darauf liegen, den Geflügelmarkt zu durchdringen.

Fazit

Gelingt es Omegga, die rein optische Methode in der Breite zu skalieren und die Genauigkeit auf die allerersten Bruttage zu trainieren, hat das Münchner Start-up einen signifikanten Hebel gegen invasiv arbeitende Wettbewerber. Die 10-Millionen-Euro-Runde ist ein klarer Vertrauensbeweis der Investor*innen in einem schwierigen Funding-Umfeld.

Spritgeld für den Start-up-Motor: PR-Stunt oder genialer Dealflow-Generator? Der neue „GründerTank“ von Christopher Obereder im Check

Reisekosten, Tankrechnungen und Bahntickets sind für junge Bootstrapping-Start-ups oft schmerzhafte Posten. Der Münchner Investor und Ex-Silicon-Valley-Macher Christopher Obereder will mit einer neuen privaten Initiative für Start-ups in Deutschland genau hier ansetzen. Ein Gesamtbudget von bis zu 100.000 Euro steht für betriebliche Mobilitätskosten bereit. Doch hinter der pragmatischen Fördermittel-Story verbirgt sich ein überaus cleveres Geschäftsmodell zur Startup-Akquise. Eine Einordnung.

Wer den GründerTank verstehen will, muss zunächst auf seinen Initiator blicken. Christopher Obereder, in der Szene oft schlicht Startup-Chris genannt, ist kein Unbekannter. Bereits 2017 landete er als 26-Jähriger auf der renommierten „Forbes 30 Under 30“-Liste. Im Silicon Valley erarbeitete er sich einen Ruf als Experte für virales Marketing. Mit Exits und Engagements bei Hit-Apps wie Tellonym baute er sich finanzielles Gewicht auf. Durch medienwirksame Formate, wie die von ihm initiierte Bayern 3 Startup Challenge, brachte er das Thema Start-up-Finanzierung einem breiten Publikum nahe. Heute leitet er von Taufkirchen aus die Start-up-Chris Ventures GmbH und investiert gezielt in junge Tech-Unternehmen.

Spritgeld statt Folien-Bingo

Mit dem GründerTank, der von Unicorn AI unterstützt wird, ruft Obereder nun eine konkrete Mobilitätsförderung ins Leben. Der Fokus liegt dabei nicht auf schönen Präsentationen, sondern auf der harten operativen Realität. Unterstützt werden können je nach Einzelfall unter anderem Kraftstoffkosten für geschäftliche Fahrten, ÖPNV-Tickets, Carsharing oder Reisen zu Messen und Investoren.

Obereders Argumentation ist bestechend pragmatisch: „Wir tanken nicht nur Autos. Wir helfen Gründerinnen und Gründern, in Bewegung zu bleiben“, erklärt der Investor. „Viele Programme sprechen über Innovation. Mich interessiert, ob Gründer wirklich unterwegs sind, Kunden treffen, Feedback einsammeln und Momentum aufbauen. [...] Wenn Bewegung im Alltag ein echter Hebel ist, soll sie nicht an ein paar Rechnungen scheitern.“

Erstes gefördertes Start-up dieser Initiative ist Kluuu, eine innovative Lernplattform, die es Studierenden ermöglicht, ihren Lernstoff in interaktive Quizze umzuwandeln. Deren Vertreter Leon Sean Brown bestätigt den Schmerzpunkt vieler Start-ups: „Die Tankpreise sind hoch, operative Wege kosten Zeit und Geld, und genau dort entsteht oft der nächste Wachstumsschritt.“ Gerade in der frühen Phase zähle jeder Euro.

Der wahre Motor: Dealflow zum Discount-Tarif

Liest man die Ankündigung, wirkt das Projekt sehr wohlwollend. Doch bei genauerer Betrachtung erweist sich der GründerTank als strategisches Meisterstück der Dealflow-Generierung für Obereders Investmentvehikel.

- Geringer Kapitaleinsatz, maximaler Einblick: Die ausgelobten 100.000 Euro sind ein Gesamtbudget. Im Gegenzug für die Chance auf die Übernahme von Zugtickets oder Tankrechnungen reichen unzählige Start-ups ihre Unterlagen und Traktionsdaten ein. Für einen professionellen Investor ist dies ein unschlagbar kostengünstiger Weg, um an hochqualitative, topaktuelle Unternehmensdaten der umtriebigsten Frühphasen-Gründer*innen des Landes zu gelangen. Reguläre Venture-Capital-Fonds geben für das Scouting ein Vielfaches dieses Budgets aus.

- Skalierung durch künstliche Intelligenz: Die Flut an Bewerbungen wird nicht mühsam per Hand sortiert. Die eingereichten Unterlagen werden zunächst KI-gestützt vorbewertet. Die KI dient ausschließlich der Vorbewertung und Priorisierung, bevor am Ende Menschen die finale Auswahl treffen.

- Exzellentes PR-Narrativ: Die Story positioniert Obereder als echten „Hands-on“-Macher und adressiert ein spürbares Problem. Ein Rechtsanspruch auf Teilnahme oder Förderung besteht dabei ausdrücklich nicht, weshalb das finanzielle Risiko für den Initiator absolut gedeckelt ist.

Fazit: Mitfahren, aber smart

Sollten junge Unternehmerinnen und Unternehmer beim GründerTank mitmachen? Die Antwort lautet: Ja, aber mit strategischem Bewusstsein. Für Bootstrapping-Teams bietet das Programm eine unkomplizierte Hilfe. Wer den Zuschlag erhält, gewinnt nicht nur finanzielle Beinfreiheit, sondern landet unweigerlich auf dem Radar eines bestens vernetzten Investors.

Gründer*innen müssen sich jedoch des Tauschgeschäfts bewusst sein: Sie gewähren tiefe Einblicke in ihr Geschäftsmodell, um im Gegenzug potenziell Mobilitätskosten erstattet zu bekommen. Man sollte das Programm daher weniger als reine Spendenaktion betrachten, sondern vielmehr als das, was es im Kern ist: Einer der innovativsten und kosteneffizientesten Start-up-Scouting-Funnel der aktuellen Szene.

BRYCK Startup Alliance: Vom Kohlenpott zum Code-Pott

Das Bundesministerium für Wirtschaft und Energie (BMWE) hat mit den exist Startup Factories ein hochambitioniertes Förderprogramm aufgesetzt. Das Ziel: Wissenschaftliche Erkenntnisse sollen schneller und skalierbarer in die Wirtschaft überführt werden. Eines der Leuchtturmprojekte entsteht derzeit im Ruhrgebiet. Wir werfen einen Blick auf den Status quo der BRYCK Startup Alliance, die Macher*innen im Hintergrund und die Frage, was das Konstrukt Gründenden in der Praxis wirklich bringt.

Deutschland habe ein Transferproblem, so die Analyse der Initiatoren. Während die heimischen Universitäten in der Grundlagenforschung weltweit Spitzengeschwindigkeiten fahren, gerate der Motor ins Stottern, sobald es darum gehe, aus diesen Erkenntnissen marktreife Unternehmen zu formen. Genau hier setzen die geförderten exist Startup Factories an. Sie haben den Auftrag, die Quantität und Qualität wissensbasierter Ausgründungen signifikant zu steigern.

Das Silicon Valley der Schwerindustrie?

Geführt wird die BRYCK Startup Alliance, die 2025 als einer der Sieger des exist-Wettbewerbs gekürt wurde, von einem fünfköpfigen Führungsteam um Geschäftsführer Philipp Herrmann. Herrmann, selbst Seriengründer und Investor, soll die Brücke zwischen akademischer Forschung und traditionellen Corporate-Strukturen schlagen. Das Ziel ist gewaltig: Das Ruhrgebiet soll sich zur führenden Modellregion für industrielle Erneuerung in Europa wandeln.

Warum aber ausgerechnet DeepTech und nicht etwa digitale B2B-Software, wo die Einstiegshürden niedriger wären? Herrmann stellt klar: „Weil wir hier nicht die x-te Region bauen sollten, die versucht, ein kleines Silicon Valley zu spielen.“ Das Ruhrgebiet habe andere Stärken, wie eine enorme Dichte an Hochschulen, Industrie und konkreten Anwendungsfeldern. Für ihn liegt die Zukunft Europas nicht in reinen Softwaremodellen, sondern in Feldern wie Energie, Wasserstoff oder industrieller Effizienz. „DeepTech hat für diese Region einen anderen Hebel“, betont er. Wenn hier etwas funktioniere, habe es echte Wirkung auf industrielle Prozesse und neue Wertschöpfung. Sein Fazit für die Region: „Nicht den schnellsten Hype, sondern den nachhaltigsten Umbau.“

Eine beispiellose Allianz – und potenzielle Corporate-Falle?

Das Fundament der Allianz ist massiv: Die Universitätsallianz Ruhr kooperiert mit der RAG-Stiftung und dem Initiativkreis Ruhr, einem Bündnis aus über 70 Konzernen wie E.ON oder RWE. Für Start-ups klinge das theoretisch nach einem Sechser im Lotto. In der Praxis jedoch drohen agile Gründer*innen oft in den bürokratischen Mühlen der Großkonzerne zu ersticken.

Herrmann räumt unumwunden ein: „Die Gefahr besteht absolut.“ Große Unternehmen seien nicht per se schnell, und Konzernprozesse könnten für junge Teams zermürbend sein. Die Allianz setze daher nicht auf bloßes Networking, sondern auf harte Vorsortierung. „Unser Job ist, viel stärker vorzusortieren: Wo gibt es ein echtes Problem? Wo gibt es auf Unternehmensseite jemanden, der das Thema wirklich treiben will?“ Ein echter „Fast Track“ sei am Ende immer ein gut vorbereiteter Prozess. Zwar werde dadurch nicht jede Reibung verschwinden, aber man könne die Wahrscheinlichkeit für erfolgreiche Pilotprojekte massiv erhöhen.

Status quo: Die Realitätsprüfung

Seit dem Start ist viel passiert: Weit über 130 Start-ups haben die Programme bereits durchlaufen. Zudem wurde mit „GF BRYCK Ventures“ ein 10-Millionen-Euro-Fonds für Frühphasen-Investments etabliert. Doch Herrmann gibt zu, dass zwischen Masterplan und Realität oft Welten liegen.

Besonders die Kluft zwischen Universität, Start-up und Konzern habe ihn in der täglichen Arbeit gefordert. Man habe gelernt, dass ein gutes Ökosystem neben einem „Nordstern“ vor allem „sehr viel operative Kleinarbeit an all den zu verändernden Schnittstellen“ benötige. DeepTech sei eben kein Sprint. „Das Ruhrgebiet verändert man auch nicht mit einer großen Überschrift“, so Herrmann. Vielmehr verändere man es Schritt für Schritt durch funktionierende Beispiele.

Der harte Weg aus dem Labor

Zwei der größten „Start-up-Killer“ bei Uni-Ausgründungen sind ungeklärte Patentrechte (IP) und einseitige Teams aus Forschenden ohne Vertriebserfahrung. Herrmann fordert hier bei den IP-Prozessen vor allem Geschwindigkeit und Verlässlichkeit. „Nichts ist schädlicher als Monate der Unklarheit.“

Gleichzeitig legt er den Fokus auf das Matching der Teams. Während die „Nerds“ aus dem Labor für die Technologie unverzichtbar seien, entstehe ein Unternehmen erst, wenn technologische Exzellenz und unternehmerische Kompetenz zusammenkommen. Er plädiert für ein neues Selbstverständnis: „Ich finde auch, wir müssen weg von diesem alten Denken, dass Forschung und Unternehmertum zwei getrennte Welten seien. Im Idealfall ist Unternehmertum der Weg, wie aus guter Forschung Wirkung wird.“

Was kostet die Förderung?

Mit dem neuen Fonds investiert die Allianz bis zu 300.000 Euro in der ganz frühen Phase. Pauschale Deal-Terms gebe es dabei bewusst nicht, da die Situationen der Teams zu unterschiedlich seien. Herrmann betont jedoch ein wichtiges Prinzip: „Frühphasenfinanzierung darf Gründer nicht klein, sondern muss sie handlungsfähig machen.“

Da 300.000 Euro bei DeepTech-Hardware oft nur ein Anfang sind, müsse man das „Valley of Death“ durch breitere Kapitalzugänge schließen. Er sieht hier eine große Aufgabe für ganz Europa: „Wir brauchen mehr geduldiges Kapital und bessere Anschlussfinanzierung für wissenschaftsbasierte Unternehmen.“ Ziel sei es, die Teams so aufzustellen, dass sie auch die nächste und übernächste Runde erreichen können.

Ausblick: Eine Milliarde fürs Ruhrgebiet

Bis 2030 sind die Ziele messbar: 1.000 wissenschaftsbasierte Ausgründungen und eine Milliarde Euro mobilisiertes Risikokapital. Ob das Projekt ein Erfolg wird, mache Herrmann an substanziellen Ergebnissen fest.

„Im Kern werden wir nur dann wirklich Strahl- und Magnetkraft auf europäischer Ebene entwickeln, wenn aus unseren Startups groß skalierte Unternehmen entstehen – wirkliche Unicorns, die Industrien verändern“, kontert er. Man müsse beweisen, dass hier Firmen entstehen, die industrielle Probleme auf Weltklasseniveau lösen. Sein Wunsch für die nächsten vier Jahre: „Dass das kein spannendes Einzelprojekt mehr ist, sondern ein funktionierendes System mit echter Zugkraft.“ Wenn die ersten Teams aus diesem System zu echten Erfolgsgeschichten werden, sei das der stärkste Beleg für den Erfolg.

Factsheet: BRYCK Startup Alliance auf einen Blick

- Offizieller Name: BRYCK Startup Alliance

- Fokus: DeepTech, B2B, industrielle Transformation

- Status: Prämierte exist Startup Factory des BMWE (Entscheidung am 10. Juli 2025)

- Geschäftsführung: Philipp Herrmann, Dr. Christian Lüdtke, Philippa Köhnk, Ersin Üstün, Maximilian Weil-Schimanski

- Wissenschaftliches Rückgrat: Universitätsallianz Ruhr (Bochum, Dortmund, Duisburg-Essen)

- Wirtschaftliches Netzwerk: Initiativkreis Ruhr (über 70 Top-Unternehmen) & RAG-Stiftung

- Finanzierung: GF BRYCK Ventures (10 Mio. Euro Fonds, Tickets bis zu 300.000 Euro)

- Ziele bis 2030: 1.000 Ausgründungen, 200 skalierende DeepTech-Start-ups, 1 Mrd. Euro mobilisiertes Kapital

- Website: bryckstartupalliance.com/de

UniteLabs: Der Münchner DeepTech-Herausforderer auf dem Weg zum globalen Labor-Standard?

Das 2024 von Robert Zechlin, Lukas Bromig und Julian Willand gegründete UniteLabs will die Laborautomatisierung von proprietären Hürden befreien. Nach einer Millionenfinanzierung folgte Anfang 2026 der offizielle US-Launch. Wir wollten wissen: Wie realistisch ist die Vision eines herstellerunabhängigen Standards in einem von Hardware-Silos dominierten Markt? Eine Analyse.

Wer heute ein hochmodernes BioTech-Labor betritt, erwartet nahtlos vernetzte HighTech-Forschung. Die Realität sieht oft anders aus: Rund 90 Prozent der Laborgeräte stammen von unterschiedlichen Hersteller*innen und sprechen schlichtweg nicht dieselbe technische Sprache. Um künstliche Intelligenz in der Forschung nutzbar zu machen, müssen hochqualifizierte Wissenschaftler*innen oft als Software-Ingenieur*innen einspringen und mühsam Schnittstellen programmieren. Genau diesen Flaschenhals will das Münchner DeepTech-Start-up UniteLabs beseitigen.

Die Gründer und der Sprung aus München

Hinter UniteLabs stehen Robert Zechlin, Lukas Bromig und Julian Willand. Nach Vorarbeiten ab 2022 wurde das Unternehmen 2024 offiziell gegründet. Das Team vereint interdisziplinäre Expertise aus Chemieingenieurwesen, Wirtschaftsinformatik und Unternehmensstrategie – eine essenzielle Mischung für ein Produkt, das tiefes Prozessverständnis mit modernster Softwarearchitektur verbinden muss.

Dass die Idee einen massiven Schmerzpunkt der Industrie trifft, zeigt die rasante Entwicklung der letzten Monate. Nach einer Pre-Seed-Finanzierungsrunde in Höhe von 2,77 Millionen Euro unter der Führung von NAP (ehemals Cavalry Ventures) im Januar 2025 und der Auszeichnung als „Bestes Münchner Start-up“ beim Munich Startup Award 2025 ist das Unternehmen sichtlich gewachsen. Im ersten Quartal 2026 zählt das Team im Münchner Inkubator Werk1 bereits rund 28 Köpfe.

Doch wie verhindert ein derart rasant wachsendes Team, bei der ständigen Anbindung neuer, exotischer Hardware nicht zu einer hochbezahlten IT-Manufaktur zu verkommen? Schließlich erfordert jedes neue Laborgerät auf dem Markt zunächst einmal Entwicklungsaufwand für den passenden Konnektor.

„Unser Ziel ist nicht, jedes exotische Gerät einzeln ‚irgendwie‘ anzubinden“, stellt Mitgründer Robert Zechlin klar. Vielmehr soll die Integration zu einer wiederholbaren Produktfähigkeit reifen. Statt sich im Klein-Klein der Modellnummern zu verlieren, baue UniteLabs seine Konnektoren entlang grundsätzlicher Geräte-Fähigkeiten. Die puren Herstellerspezifika landen dabei in einer dünnen Adapter-Schicht, während Workflows und Datensemantik konsistent bleiben.

Um die berüchtigte Skalierungsfalle zu umgehen, setzt das Start-up zudem verstärkt auf „Reusable Automation Assets“. „Wir investieren in validierte Workflow-Bausteine, Device-Profile und Test-Suites, mit denen die zweite und dritte Integration deutlich schneller wird als die erste“, betont Zechlin und skizziert damit den Weg zum echten SaaS-Unternehmen. Der Gründer gibt die Richtung selbstbewusst vor: „Die Grenzkosten für das nächste Gerät und den nächsten Standort müssen über Zeit sinken. Unser Endzustand ist ein Ökosystem, in dem Integrationen gemeinsame Infrastruktur sind, nicht Projektgeschäft.“

Vom Prototyp zur Architektur der offenen Labore

Im Februar 2026 hat UniteLabs auf der renommierten Branchenmesse SLAS in Boston den offiziellen US-Launch seines „AI-Ready Lab Automation Systems“ vollzogen. Statt nur isolierte Schnittstellen zu flicken, positioniert sich das Start-up nun mit einer klaren, dreiteiligen Architektur.

Den Kern bildet die Cloud-native „UniteLabs Platform“, die Hardware vernetzt und die Integration von Machine-Learning-Modellen in Echtzeit erlaubt. Ergänzt wird dies durch die lokale Anwendung „GroundControl“ für den Plug-and-Play-Anschluss von Geräten sowie das „UniteLabs SDK“. Letzteres ist ein Python-Werkzeug für Wissenschaftler*innen, um Labor-Workflows komplett als Code zu steuern. Dass diese Theorie praxistauglich ist, beweist das aufstrebende KI-BioTech-Unternehmen Cradle, das die Lücke zwischen Maschinen und digitalen Daten-Lakes intern bereits mit dem Münchner System schließt. Laut UniteLabs soll sich der Labor-Durchsatz für solche KI-getriebenen Forschungsteams durch die Plattform um bis zu das Vierfache steigern lassen.

Ein „Lab-as-Code“-Ansatz via Python mag für entwickleraffine Data Scientists verlockend sein – doch schließt er nicht paradoxerweise die klassischen Biolog*innen aus, für die Code-Workflows oft eine zu steile Lernkurve bedeuten?

„Code ist nicht das Produkt“, kontert Zechlin. Er sei vielmehr eine Schnittstelle, die sowohl Power-User als auch den Laboralltag bedienen müsse. Das SDK richte sich an Teams, die volle Kontrolle über Versionierung und automatisierte Tests verlangen – was im KI-BioTech-Umfeld zunehmend Standard sei. Zechlin räumt jedoch ein, dass das Programmieren nicht jedem liege: „Die meisten wollen zuverlässige Ausführung und klare Transparenz.“

Die Lösung der Münchner: Über die Orchestrierungsschicht und „GroundControl“ werden Workflows paketiert und mit Leitplanken versehen, sodass sie auch für Nicht-Entwickler sicher ausführbar sind. Code bleibt strategisch zwar die „universelle Abstraktion“ über Geräte hinweg, doch das Interface der Zukunft sieht anders aus. Zechlin blickt voraus: „Das User Interface für Wissenschaftler wird zunehmend KI-gesteuert und natürliche Sprache zum primären Interface. UniteLabs dient diesen KI-Applikationen als robuste Surface Area und Source of Truth.“ Die Leitplanke für das Wachstum fasst er in einem Satz zusammen: „Unsere Vision ist: flexibel, wo es Sinn macht, und kompromisslos robust, wo es zählen muss.“

Die Bewährungsprobe auf dem US-Markt

Nach dem Bostoner Launch steht das Start-up nun vor der monumentalen Aufgabe, sich im hochkompetitiven US-Markt zu behaupten. Hier entscheidet sich, ob UniteLabs vom europäischen Hoffnungsträger zum globalen Player reift. Umgeben von gigantischen Investitionen in die KI-Wirkstoffentwicklung reicht es nicht, nur ein weiteres Automatisierungstool zu sein – UniteLabs muss sich als essenzieller „Schaufelhersteller“ für den aktuellen Boom etablieren.

Dabei trifft man auf amerikanische Wettbewerber*innen, die teils mit hunderten Millionen Dollar Venture Capital ausgestattet sind. Wie überlebt ein Münchner Start-up mit einer Pre-Seed-Runde von knapp drei Millionen Euro diese Materialschlacht? Zechlin gibt sich pragmatisch und weicht dem direkten Finanz-Vergleich aus: „Klar: In Infrastrukturmärkten hilft Kapital, aber es ist nicht der entscheidende Hebel.“ Anstatt die Konkurrenz im reinen „Spend“ schlagen zu wollen, baue man auf messbaren Nutzen im Laborbetrieb.

Der Plan scheint aufzugehen: Ein Großteil von Umsatz und Pipeline stammt heute bereits aus den USA, wo UniteLabs Kund*innen an beiden Küsten bedient und mit großen Hardware-Hersteller*innenn kooperiert. „Wir planen für dieses Jahr unseren ersten Big Pharma Roll-out, der sowohl in Europa als auch an Standorten in den USA erfolgen soll“, verrät der Gründer. Um diese Dynamik zu finanzieren, hebe man aktuell eine 9-Millionen-Euro-Seed-Runde für die US-Expansion. Den strukturellen Wettbewerbsvorteil sieht Zechlin in der herstelleragnostischen Verbindung bestehender Geräte: „Statt Rip-and-Replace zu verlangen, werden Workflows schneller produktiv, Daten werden sauber mit Kontext versehen, und Teams können ‚Lab-as-Code‘ wirklich ausrollen.“

Ein strategischer Hebel ist dabei die Zielgruppenansprache. Statt in endlosen Vertriebszyklen mit dem C-Level großer Pharma-Konzerne zu ringen, treibt UniteLabs ein nutzer*innengetriebenes Wachstum voran. Labor-Ingenieur*innen, die durch das Python-SDK wochenlange Schnittstellenprogrammierung einsparen, tragen das System organisch in ihre Unternehmen. Dabei profitiert das Start-up enorm davon, selbst keine Pipettierroboter oder Analysegeräte herzustellen. Als „neutrale Schweiz“ der Labor-Hardware buhlt UniteLabs nicht um lukrative Geräteverkäufe – ein extrem starkes Argument gegen den gefürchteten Vendor-Lock-in amerikanischer Hardware-Giganten.

Stresstest für das Geschäftsmodell und Regularien

Doch die ambitionierte Plattform-Strategie wird kritisch geprüft werden. Das Geschäftsmodell birgt ein ständiges API-Katz-und-Maus-Spiel, da Schnittstellen zu teils stark abgeschirmten Systemen gebaut werden müssen. Wenn etablierte Hersteller*innen ihre Firmware ändern oder Drittanbieter-Zugriffe blockieren, explodieren schnell die Wartungskosten für die Konnektoren.

Bleibt die Frage an den Gründer: Was ist also der Plan B, wenn die Marktführer ihre Schnittstellen per Update plötzlich aktiv verschlüsseln? Reicht der Verweis auf offene Standards wie das SiLA2-Protokoll in der harten Praxis aus?

„Wir gehen davon aus, dass Hersteller ihre Ökosysteme schützen werden. Unsere Strategie darf deshalb nicht auf ‚Goodwill‘ bauen“, gibt sich Zechlin keinen Illusionen hin. Standards wie SiLA2 seien zwar hilfreich gegen Fragmentierung, aber „kein Schutzschild“. Der Ansatz der Münchner ist stattdessen pragmatisch und mehrstufig: Standards nutzen, wo verfügbar, und eigene robuste Adapter bauen, wo nötig. Zudem betreibe man ein Programm mit automatisierten Regressionstests am realen Geräteverhalten, um Fehler durch Updates früh zu erkennen.

Der zweite Baustein der Verteidigung ist kommerzieller Druck. Da Labore zunehmend „Best-of-Breed“-Lösungen kombinieren wollen, würden Hersteller, die Interoperabilität blockieren, zunehmend Deals riskieren. Im Hintergrund investiere man deshalb viel Arbeit in aktiv gepflegte Partnerschaften mit den Produzent*innen. Zechlins Plan B lautet letztlich Resilienz: „Mehrere Integrationspfade, starke Tests, und ein System, das stabil bleibt, auch wenn sich die Oberfläche verändert.“ Er ist sich sicher: „Langfristig wirkt die Ökonomie in Richtung Offenheit.“

Neben blockierender Hardware bleibt die US-Zulassungsbehörde FDA die vielleicht höchste Hürde auf dem Weg in den Enterprise-Markt. Deren strenge Vorgaben zu elektronischen Aufzeichnungen sind der größte Vorbehalt von Pharmaunternehmen gegenüber Cloud-basierten Systemen. Gelingt es UniteLabs, Offenheit mit lückenlosen Audit-Trails zu verknüpfen, könnten sie die berüchtigten Sales-Zyklen drastisch verkürzen.

Doch wie passt maximale Entwickler*innen-Freiheit durch Python-Skripte mit rigider FDA- und GxP-Compliance zusammen? Für Zechlin existiert dieser Widerspruch im Labor-Alltag schlichtweg nicht: „Compliance widerspricht Flexibilität nicht. Was widerspricht, ist unkontrollierte Veränderung.“

Um Big Pharma gerecht zu werden, behandle man hochflexible Workflows wie reguläre Software-Produkte: versioniert, testbar und auditierbar. „Ein Script ist in einem GxP-Kontext kein ‚jeder macht, was er will‘, sondern ein kontrolliertes Artefakt mit definierten Inputs, erwarteten Outputs und einem Validierungsnachweis“, unterstreicht der Mitgründer. Die Plattform trenne Sandbox-Entwicklungen von einer strikt kontrollierten Produktionsebene mit signierten Releases, Environment-Pinning und klarer Datenlineage. Zechlin formuliert einen selbstbewussten Anspruch an die Branche: „Das Labor holt Software-Best-Practices nach. Unser Anspruch ist, ‚compliant by design‘ zur Default-Einstellung für AI-ready Lab Ops zu machen.“

Fazit

UniteLabs hat exzellentes Timing bewiesen. Die BioTech-Branche lechzt nach KI, scheitert aber noch massenhaft an isolierten Daten. Durch das Bereitstellen essenzieller Daten-Infrastruktur haben sich die Münchner in eine starke Ausgangsposition manövriert. Der US-Launch und anstehende Messepräsentationen zeugen vom Anspruch der Gründer. Der ultimative Lackmustest ab 2026 wird jedoch sein, ob die Hardware-Hersteller*innen diesen Wandel dulden – oder den Kampf um ihre lukrativen Software-Margen eröffnen.

Bleibt die Frage nach dem viel zitierten „Endgame“: Baut das Start-up wirklich das globale Betriebssystem für Biotech-Labore, oder macht man sich letztlich nur als hochattraktives Übernahmeziel für Hardware-Giganten hübsch?

Auf diese Entweder-Oder-Frage antwortet Zechlin diplomatisch, aber ambitioniert: „Unsere Vision ist, die neutrale Betriebsschicht für moderne Labore zu werden, weil die Branche einen herstellerunabhängigen Standard braucht, nicht noch ein weiteres Einzellösungstool.“ Gleichzeitig sei man Realist: Infrastruktur zähle nur, wenn sie im Alltag zuverlässig genutzt werde und verlässliche, strukturierte Daten für KI liefere.

Sollte das gelingen, hält sich UniteLabs alle Optionen offen – von der unabhängigen Kategorie-Definition über strategische Partnerschaften bis hin zum Exit. Doch auf einen schnellen Verkauf schiele man nicht, verspricht Zechlin: „Wir bauen nicht für eine Übernahme. Wir bauen so, dass der Markt die Plattform ernst nehmen muss.“ Und am Ende solle ohnehin der/die Kund*in profitieren: „Weniger Silos, schnellere Science, und ein Ökosystem, in dem Innovation nicht an proprietären Schnittstellen hängen bleibt.“

Openlaw sichert sich 3,3 Mio. US-Dollar für digitale Rechtsinfrastruktur

3,3 Mio. USD gegen Europas Bürokratie: Das LegalTech-Start-up Openlaw automatisiert mit beglaubigt.de den Gründungsprozess als digitale Infrastruktur.

Die europäische Plattform für digitale Rechts- und Notarinfrastruktur Openlaw hat eine Seed-Finanzierungsrunde in Höhe von 3,3 Millionen US-Dollar abgeschlossen. Das 2024 gegründete Münchner LegalTech-Start-up, das im Heimatmarkt vor allem unter der Marke beglaubigt.de agiert, will mit dem frischen Kapital den bürokratischen Gründungs- und Verwaltungsprozess in Europa radikal vereinfachen. Zu den Geldgebern zählen unter anderem YouTube-Mitgründer Jawed Karim über Y Ventures, Moonfire Ventures (gegründet von Atomico-Cofounder Mattias Ljungman), Zeno Ventures, Combination VC, Orange Collective sowie diverse Business Angels und Alumni des Y Combinators.

Von der Unicorn-Skalierung zur Infrastruktur: Die Gründerhistorie

Hinter Openlaw stehen zwei Köpfe mit beachtlicher Start-up-Vita, die den Schmerz der europäischen Bürokratie aus eigenen Gründungs- und Skalierungsphasen kennen:

Alexander Sporenberg (CEO): Er gehörte zum Gründungsteam der Razor Group, einem E-Commerce-Aggregator, der in nur 15 Monaten zum Unicorn mit einer Bewertung von 1,7 Milliarden US-Dollar aufstieg. Bei hunderten M&A-Deals erlebte Sporenberg Notartermine und Registerprozesse als massives Nadelöhr für das Unternehmenswachstum.

Felix Gerlach (CPO): Nach seiner Zeit im Ökosystem von Rocket Internet gründete Gerlach die Identity-Verification-Plattform Passbase. Nachdem internationale US-Investoren einstiegen, wurde das Unternehmen 2023 an Parallel Markets verkauft. Seine Expertise im Aufbau skalierbarer Infrastrukturen fließt nun in die Produktentwicklung bei Openlaw.

Mit diesem Background schaffte es das Duo in das hochkompetitive Programm des kalifornischen Y Combinators (F24 Batch). Durch die Zeit in San Francisco verfestigte sich die Vision, die technologische Lücke zwischen dem US-Markt, wo Gründungen teils in nur 24 Stunden abgeschlossen sind, und dem europäischen Flickenteppich aus 27 Rechtssystemen und über 60 Gesellschaftsformen zu schließen.

API-First statt Papierkrieg

Das Kernversprechen von beglaubigt.de ist eine drastische Effizienzsteigerung durch die Digitalisierung des administrativen Überbaus. Während eine reguläre GmbH-Gründung in Deutschland meist sechs bis acht Wochen in Anspruch nimmt, will Openlaw diesen Prozess laut eigenen Angaben auf bis zu drei Tage drücken.

Dabei agiert das Start-up explizit nicht als Ersatz für bestehende Institutionen. Vielmehr fungiert das Modell als prozessoptimierende Schicht für Gründer*innen:

Die Plattform übernimmt die Administration, die Terminkoordination, die Dokumentenvorbereitung sowie die Registeranmeldungen. Dafür arbeitet beglaubigt.de regelmäßig mit einem Netzwerk aus rund 300 Notariaten zusammen. Die originär hoheitlichen Aufgaben – die juristische Beratung, rechtliche Belehrung und die eigentliche Beurkundung – verbleiben zwingend bei den kooperierenden Notariaten.

Ein wesentlicher USP und Skalierungshebel ist die technologische Anbindung an Drittanbieter. Openlaw betreibt eine vollautomatisierte "Incorporation API". Diese erlaubt es Partnern wie den Neobanken Qonto und Holvi oder dem Buchhaltungstool Sevdesk, den gesamten Gründungsprozess nativ in ihre eigenen Workflows zu integrieren. Ein(e) Kund*in kann so beispielsweise im Rahmen einer Kontoeröffnung bei Qonto direkt die Unternehmensgründung mit anstoßen, ohne die Plattform wechseln zu müssen. Bis heute hat das rund 20-köpfige Team nach eigenen Unternehmensangaben über 25.000 Kund*innen über die Plattform betreut.

Marktumfeld und Wettbewerb

Dass eine Beschleunigung im Ökosystem not tut, ist unumstritten. Laut dem DIHK-Report 2025 sind beinahe 60 Prozent der Gründer*innen mit dem Standort Deutschland unzufrieden; drei Viertel fordern deutlich schnellere und einfachere Regularien. Die Politik versucht zwar auf europäischer Ebene, mit Vorstößen wie der EU Inc. die Entbürokratisierung voranzutreiben. Doch was nach der eigentlichen Gründung folgt – wie Steuerregistrierung, Handelsregister, Geschäftsadresse und laufende Administration – bleibt hochkomplex und national geregelt. Zudem muss in Kernmärkten wie Deutschland, Spanien und Frankreich die Unternehmensgründung notariell beurkundet werden.

In diesem Setup muss sich das Geschäftsmodell von Openlaw bewähren und kritischen Fragen stellen:

- Der harte Flaschenhals des Notarmonopols: So reibungslos Openlaw den Prozess per Software orchestriert, am Ende bleibt das Tempo durch die Kapazitäten der angeschlossenen Notariate und Amtsgerichte limitiert. Openlaw optimiert den Weg zum und vom Notariat sowie den administrativen Overhead, kann die Institution selbst aufgrund gesetzlicher Vorgaben aber nicht disruptieren.

- Dicht besiedelter Wettbewerb: Der Markt für „Gründung als Service“ in Deutschland ist umkämpft. Etablierte Player wie firma.de, Rechtstech-Kanzleien (z.B. Recht24/7) oder hochspezialisierte Anbieter wie RIDE (Fokus auf vermögensverwaltende GmbHs und Holding-Strukturen) bedienen die Sehnsucht nach administrativen Abkürzungen schon länger.

- Der strategische Vorteil durch B2B: Der entscheidende Differenzierungsfaktor von Openlaw scheint weniger das Endkund*innengeschäft zu sein, sondern der radikale API-First-Ansatz. Gelingt es, die eigene Schnittstelle als unsichtbare Standard-Infrastruktur in europäische FinTech-Lösungen und Banking-Apps einzuweben, profitiert Openlaw von massiven Lock-in-Effekten und senkt gleichzeitig die Customer Acquisition Costs (CAC), da Partner wie Qonto oder Sevdesk den Traffic liefern.

Ausblick

Mit dem frischen Kapital will Openlaw das Produktangebot seiner deutschen Marke gezielt ausbauen. Neben Standardgründungen (GmbH, UG, GbR) und steueroptimierten Holding-Strukturen sollen künftig auch weitere Registerprozesse sowie die laufende Buchführung vollständig über die Plattform abgewickelt werden. Das langfristige Ziel bleibt dabei die Expansion in weitere europäische Märkte, um Gründer*innen eine grenzübergreifende digitale Infrastruktur für den laufenden Betrieb zu bieten.

Gründer*in der Woche: Little World – Spracherwerb durch echte Begegnung

Wie Oliver Berlin mit seinem Aachener Social-Start-up Little World trotz beachtlichen Erfolgs vor der großen Herausforderung der Anschlussfinanzierung steht – und was das über ein strukturelles Defizit in unserem Fördersystem verrät.

Es ist eine dieser Geschichten, die eigentlich ein Happy End haben müssten. Die Zahlen stimmen, die gesellschaftliche Wirkung ist messbar, und die Menschen sind begeistert. Doch Oliver Berlin, Wirtschaftsingenieur und Gründer des Social-Start-ups Little World, blickt derzeit nicht auf Erfolgsstatistiken, sondern auf ein finanzielles Problem. Sein Projekt offenbart ein strukturelles Defizit in unserem Fördersystem und steht vor einer massiven Herausforderung, da eine essenzielle Förderung Ende 2025 ausgelaufen ist.

Spracherwerb durch echte Begegnung

Die Vision von Little World ist so simpel wie effektiv: Menschen, die Deutsch sprechen, treffen sich im digitalen Raum mit Menschen, die Deutsch lernen. Es geht dabei nicht um klassische Nachhilfe oder sture Grammatik, sondern um echten Austausch auf Augenhöhe über den Alltag, Hobbys und die Familie.

Auslöser für die Gründung war Berlins eigene Erfahrung während der Pandemie, als er beobachtete, wie seine Mutter täglich ältere Menschen anrief, um ihnen Gesellschaft zu leisten. Zusammen mit Tim Schupp und Sean Blundell fusionierte er 2022 diese Idee zu Little World. Der Erfolg ließ nicht lange auf sich warten. Innerhalb der ersten drei Monate nach dem Launch verzeichnete die Plattform bereits 1.000 Anmeldungen. Heute vernetzt das Start-up bundesweit rund 6.500 Menschen und vermittelt jährlich etwa 1.200 Gesprächspaare.

Wie die Community über sich hinauswächst

Dass Little World weit mehr ist als eine reine Vermittlungsmaschine, zeigt sich daran, wie sich das Angebot mittlerweile organisch aus der Community heraus weiterentwickelt. Neben den 1-zu-1-Gesprächen gibt es inzwischen auch von den Teilnehmenden selbst initiierte Gruppenformate, wie etwa den neuen Online-Buchclub.

Ins Leben gerufen wurde dieser von der 27-jährigen Varvara, die selbst erst seit Anfang 2025 als Deutschlernende auf der Plattform aktiv ist. Ihr eigenes Deutsch hat sie sich maßgeblich durch das Lesen erarbeitet. Nun gibt sie diese Leidenschaft weiter: Alle zwei Wochen treffen sich im virtuellen Lesekreis Lernende und Freiwillige, um über vorab vereinbarte Texte zu sprechen – die Bandbreite reicht von Harry Potter bis Franz Kafka. In kleinen Breakout-Rooms geht es dabei weniger um strenge Literaturkritik, sondern vielmehr darum, das freie Sprechen zu üben und eigene Erfahrungen zu teilen.

Das Paradoxon des Erfolgs: Wenn die Förderung wegbricht

Es sind genau diese Momente der Begegnung und Integration, die aktuell auf dem Spiel stehen. Denn während die Community wächst und floriert, tickt im Hintergrund die finanzielle Uhr. Eine substanzielle Förderung der Deutschen Fernsehlotterie in Höhe von 400.000 Euro, die dem Start-up zwei Jahre lang Luft zum Atmen und Wachsen gab, ist Ende 2025 ausgelaufen. Das Kernteam wurde zwar vergrößert, doch die laufenden Betriebskosten für Server, technischen Support und das Matchmaking bleiben …

Hier schnappt die Falle des deutschen Fördersystems zu. Stiftungen und staatliche Töpfe finanzieren gerne den innovativen Aufbau oder Pilotphasen. Ist ein Projekt jedoch etabliert und läuft erfolgreich, ziehen sich die Geldgeber*innen zurück. Sozialunternehmer wie Oliver Berlin verbringen infolgedessen oft mehr Zeit mit dem Schreiben von Anträgen als mit ihrer eigentlichen gesellschaftlichen Mission.

Kooperationen statt Rückzug

Trotz des immensen Drucks richtet das Team den Blick nach vorn und setzt auf eine strategische Neuausrichtung. Jüngst schloss Little World ein Bündnis mit Lern-Fair, einem Verein zur Unterstützung bildungsbenachteiligter Schüler*innen. Durch diese Zusammenarbeit sollen Ressourcen geteilt und neue Zielgruppen, wie etwa Eltern, erschlossen werden.

Zusätzlich rückt die Wirtschaft stärker in den Fokus. Das Social Start-up positioniert sich zunehmend als Tool für Unternehmen, die ihren Mitarbeitenden über Corporate Volunteering ein unkompliziertes Engagement ermöglichen wollen. Gleichzeitig können Firmen so frühzeitig Kontakt zu internationalen Talenten aufbauen. Um das Modell auf breitere Schultern zu stellen und die Struktur langfristig zu sichern, sollen neben Spenden künftig auch Stiftungen und Unternehmen eine entscheidende Rolle spielen. „Sprachvermittlung ist unser Vehikel – unser Ziel ist gesellschaftlicher Zusammenhalt“, appelliert Berlin.

Steckrübe statt Schwein: Verrano sichert sich hohe sechsstellige Finanzierung für die „Clean Label“-Revolution

Das 2023 gegründete Frankfurter Start-up Verrano hat ein neuartiges Verfahren entwickelt, das regionales Wurzelgemüse durch Reifung und Räucherung in eine pflanzliche Alternative zu Wurstersatzprodukten verwandelt.

Hinter Verrano, das Anfang 2023 in Frankurt/Main gegründet wurde, steht ein branchenerfahrenes, dreiköpfiges Gründerteam rund um Geschäftsführer Manuel Siskowski. Die Idee reifte jedoch schon lange vor der formellen Gründung. Getreu dem internen Motto „natürlich köstlich“ experimentierten die Gründer – zu denen auch Maximilian Bubenheim mit seiner Erfahrung aus der Sternegastronomie sowie Felix Linnenschmidt gehören – mehrere Jahre mit Wurzelgemüse.

Dabei wendeten sie ein Verfahren an, das in ähnlicher Form beim Reifen von klassischem Schinken zum Einsatz kommt. Nach ersten erfolgreichen Testläufen im regionalen Bio-Handel konnten bald die ersten Kund*innen mit Mengen aus der in Biebertal bei Gießen installierten Pilotanlage beliefert werden.

Handwerkstradition trifft Gemüse

Anstatt klassische Fleischersatzprodukte nachzuahmen, setzt Verrano auf die handwerkliche Veredelung. Regionale Rohstoffe wie Steckrübe, Sellerie und Rote Beete werden einem speziellen Fermentations- und Räucherverfahren unterzogen. Das Endprodukt zeichnet sich durch einen enormen Gemüseanteil von rund 95 Prozent aus und kommt mit nur wenigen Zutaten aus, ohne künstliche Zusatzstoffe zu verwenden. Das Ergebnis soll laut Unternehmensangaben in seiner Textur und dem Geschmack an hochwertige Fleischprodukte wie Schinken erinnern. Die kulinarischen Kreationen werden bereits als dünner Aufschnitt, im Würfelmix oder am Stück in den Markt eingeführt und eignen sich flexibel als Brotbelag, zum Kochen oder für Snackplatten. Die Innovationskraft dieses Ansatzes wurde kürzlich von PETA mit dem „VEGAN AWARD 2026“ in der Kategorie „beste vegane Innovation“ ausgezeichnet.

Eine neue Kategorie jenseits der Imitation

Der Markt für pflanzliche Alternativen konsolidiert sich aktuell, während die Lebensmittelbranche verstärkt nach innovativen pflanzlichen Produkten sucht, die neue Geschmackserlebnisse erzeugen. Hier positioniert sich Verrano in der stark wachsenden Nische der „Clean Label“-Produkte. Direkte Wettbewerber*innen mit einem identischen Ansatz sind rar, da die meisten großen Player*innen weiterhin auf Extrusionsverfahren von Proteinisolaten setzen. Verrano erschafft vielmehr eine neue Kategorie: Eine pflanzliche Feinkost, die das Naturprodukt Gemüse transformiert. Dass diese Nische massentauglich ist, bewies das Start-up jüngst im Veganuary durch aufmerksamkeitsstarke Listungen deutschlandweit in den Bordbistros der Deutschen Bahn.

Die Herausforderungen am Markt

Trotz der vielversprechenden Traction und der Skalierbarkeit, die bereits mit der Pilotanlage bewiesen wurde, steht das Start-up vor großen operativen Herausforderungen, um den Start im breiten Handel zu ermöglichen. Ein Reifeprozess, der Wochen in Anspruch nimmt, bindet extrem viel Working Capital, da enorme Mengen vorproduziert und gelagert werden müssen. Zudem verhält sich Gemüse im Reifeprozess mikrobiologisch grundlegend anders als Fleisch. Die Qualitätssicherung erfordert hochpräzise Produktionsumgebungen, um die Haltbarkeit bei größeren Mengen zu garantieren. Letztlich bedarf es auch starker Aufklärungsarbeit und forcierter Vertriebsaktivitäten am Konsument*innen, um Wurzelgemüse dauerhaft als Premium-Feinkostprodukt zu etablieren.

Reale Skalierung statt VC-Hype

Genau bei diesen Herausforderungen zeigt sich die strategische Passung der aktuellen Finanzierungsrunde. Dass Verrano die bestehenden Produktionskapazitäten massiv ausweiten muss, um die ansteigende Nachfrage zu bedienen, ist der klassische Flaschenhals von Food-Start-ups. Der überwiegende Teil der eingeworbenen Mittel fließt in genau diesen Zweck. Dass die Finanzierungsrunde dabei, wie StartingUp aus Branchenkreisen erfuhr, im hohen sechsstelligen Bereich liegt, beweist die Kapitaleffizienz des Unternehmens. Anstatt reines Risikokapital in teure Eigenentwicklungen zu pumpen, setzt Verrano auf „Smart Money“.

Mit dem Maschinenbauer Weber Food Technology und der Wurst- und Schinkenmanufaktur Bedford holen sie sich zwei strategische Industrie-Schwergewichte an Bord. Verrano profitiert hier direkt von jahrzehntelanger Expertise in der mikrobiologischen Reifung sowie im industriellen High-Tech-Slicing. Zusammen mit der BMH, die als VC-Tochter der Helaba aktuell Fonds mit einem Volumen von 450 Millionen Euro verwaltet, hat das Start-up starke Partner für die anstehende Geschäftsentwicklung gewonnen. Dieses Konsortium bietet das Rüstzeug, um die Nische der veganen Boutiquen zu verlassen und den Lebensmitteleinzelhandel zu adressieren.

Griff nach den Sternen: Lieferando- und Tier-Mitgründer sammelt 5 Mio. Euro für Solarenergie aus dem All

Das europäische Start-up TerraSpark will sauberen Strom per Funk aus dem Orbit zur Erde schicken. Mit dabei: der Deutsche Matthias Laug, Mitgründer von Lieferando und Tier Mobility, sowie deutsche Investoren. Wir wollten wissen: Wie realistisch ist das ehrgeizige Vorhaben der Tech- und Raumfahrt-Veteranen? Eine Einordnung.

Europas Energieinfrastruktur stößt zunehmend an ihre Grenzen. Während die Internationale Energieagentur (IEA) prognostiziert, dass sich der Strombedarf von Rechenzentren bis 2030 mehr als verdoppeln wird, zeigten großflächige Stromausfälle in Spanien und Portugal zuletzt die Schwächen der heutigen Energiesysteme auf.

Eine radikale Lösung für dieses drängende Problem verspricht nun das 2025 in Luxemburg gegründete Start-up TerraSpark. Das junge Unternehmen hat eine Pre-Seed-Finanzierungsrunde in Höhe von über fünf Millionen Euro erfolgreich abgeschlossen. Zu den Geldgebern zählen neben der Pariser Gesellschaft Daphni und dem Tech-Investor Sake Bosch auch die Angel-Investoren-Allianz better ventures und die Hans(wo)men Group. Ihr gemeinsames Ziel: Weltraumgestützte Solarenergie kommerziell nutzbar zu machen.

Prominente deutsche Wurzeln in einem hochkomplexen Hardware-Projekt

Dass dieses Vorhaben für die hiesige Gründerszene von besonderem Interesse ist, liegt maßgeblich an der personellen Aufstellung. Hinter TerraSpark steht ein Gründertrio, das eine seltene Kombination aus europäischer Raumfahrtexpertise und massiver Skalierungserfahrung vereint. Aus deutscher Sicht sticht hierbei besonders Chief Operating Officer Matthias Laug hervor. Als Mitgründer von Lieferando und Tier Mobility bringt er tiefe Erfahrung im Aufbau und in der Skalierung großer europäischer Plattformunternehmen in das komplexe Projekt ein.

Geführt wird das Team von CEO Jasper Deprez, einem Seriengründer, der zuvor die globale HR-Tech-Plattform Tradler aufbaute. Die zwingend notwendige Raumfahrt-Expertise liefert Chief Technology Officer Dr. Sanjay Vijendran: Er verantwortete bei der Europäischen Weltraumorganisation (ESA) bereits das Solaris-Programm zur weltraumgestützten Solarenergie und war an der Mars Sample Return Mission beteiligt. Auch auf Investor*innenseite ist das deutsche Vertrauen in das Team groß. Tina Dreimann, Gründerin und Geschäftsführerin von better ventures, lobt genau diese Mischung aus europäischer Raumfahrtkompetenz und der Erfahrung, Technologie wirklich zu skalieren.

Erst die Erde, dann das All

Die Vision des Trios ist gewaltig: Solarenergie soll im Weltraum eingefangen und per Funkfrequenz sicher zur Erde übertragen werden. Das Konzept ist in der Theorie bereits seit den 1970er Jahren bekannt, doch erst heute machen sinkende Startkosten sowie technologische Fortschritte in der Satellitenfertigung und Orbitrobotik die Umsetzung wirtschaftlich tragfähig.

Anstatt jedoch das immense Risiko einzugehen und sofort mit gigantischen Systemen im All zu beginnen, wählt TerraSpark bewusst einen schrittweisen Kommerzialisierungs-Ansatz. Das Startup startet auf der Erde mit der Kommerzialisierung funkfrequenzbasierter drahtloser Energieübertragung für industrielle Anwendungsfälle. Mit diesem pragmatischen Schritt sollen Sicherheit, Effizienz und regulatorische Kompatibilität im kleinen Maßstab demonstriert werden, bevor das System in den Orbit skaliert wird. Ein hochrelevanter Markt für diese erste Phase sind netzferne Regionen, die bislang auf Dieselgeneratoren angewiesen sind. Dort liegen die Stromkosten häufig bei etwa 0,70 bis 1,50 Euro pro Kilowattstunde – ein starkes Preissignal, das technologische Alternativen rasch wirtschaftlich attraktiv machen kann.

Um diesen Markt zu erschließen, bereitet das Unternehmen in den kommenden Monaten erste Pilotanwendungen vor, darunter die drahtlose Energieversorgung eines Live-Events. Auch die Roadmap für den Weg ins All steht: Ein erster orbitaler Technologie-Demonstrator ist für das Jahr 2027 geplant, die erste echte Weltraum-zu-Erde-Energieübertragung wird für 2028 anvisiert.

Markt, Wettbewerb & Machbarkeit

Obwohl die Physik hinter der funkfrequenzbasierten Energieübertragung laut CTO Sanjay Vijendran seit Jahrzehnten validiert ist, bleibt die weltraumgestützte Solarenergie ein extrem komplexes Unterfangen. TerraSpark ist auf diesem kapitalintensiven Spielfeld nicht allein. Neben Start-ups wie Virtus Solis aus den USA oder dem neuseeländisch-deutschen Unternehmen Emrod haben auch etablierte Luft- und Raumfahrtgiganten wie Airbus das enorme wirtschaftliche Potenzial längst erkannt und treiben eigene Forschungsprogramme voran.

Kritisch zu hinterfragen bleibt bei all diesen Vorhaben die technische Effizienz der Energieübertragung über gewaltige Distanzen bis hinunter zur Erde. Die Errichtung großflächiger Solarpaneele im Weltall erfordert trotz signifikant sinkender Frachtpreise weiterhin immense Vorabinvestitionen und unzählige Raketenstarts. Zudem muss der internationale regulatorische Rahmen für das Richten von hochkonzentrierten Funkwellen aus dem All auf irdische Empfangsstationen erst noch global abgestimmt werden.

Fazit

Der „Earth-first“-Ansatz von TerraSpark ist ein äußerst kluger, unternehmerischer Schachzug. Er mildert das finanzielle Risiko für die Seed-Investoren ab, demonstriert Technologie greifbar im Kleinen und könnte frühe B2B-Umsätze generieren, lange bevor die erste Hardware ins All fliegt. Dennoch bleibt der Meilenstein-Plan enorm ambitioniert. Matthias Laug und seine Mitstreiter*innen haben in der Vergangenheit zwar eindrucksvoll bewiesen, dass sie digitale und urbane Geschäftsmodelle massiv skalieren können. Der Schritt vom E-Scooter-Verleih zur interplanetaren Energie-Infrastruktur erfordert in den kommenden Jahren jedoch eine völlig neue Dimension der Exekution – und noch deutlich tiefere Taschen der Investor*innen.

Mediennutzung 2026: Zwischen KI-Frust, Abo-Müdigkeit und neuen Chancen für Start-ups

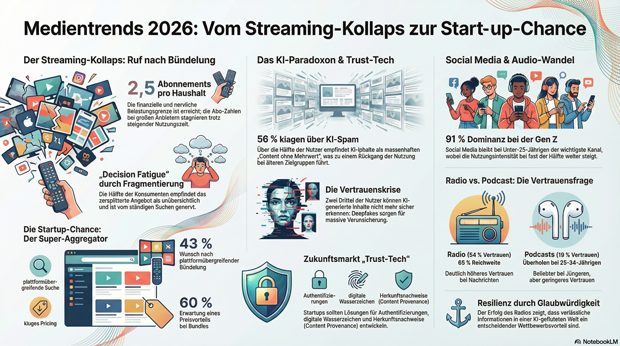

Die Deutschen experimentieren so intensiv wie nie mit künstlicher Intelligenz (KI), sind aber zunehmend genervt von Deepfakes und „Content ohne Mehrwert“. Gleichzeitig sehnt sich der überhitzte Streaming-Markt nach einer drastischen Konsolidierung. Die aktuelle Deloitte-Studie „Media Consumer Trends 2026“ liefert nicht nur Bestandsaufnahmen, sondern zeigt deutlich, wo für Gründer*innen und Tech-Unternehmen jetzt die wahren Opportunitäten liegen.

Social Media bleibt der unangefochtene Platzhirsch der Medienlandschaft: 78 Prozent der Konsument*innen in Deutschland sind auf den Plattformen aktiv, bei der Gen Z (unter 25 Jahre) sind es sogar satte 91 Prozent. Fast die Hälfte dieser jungen Zielgruppe nutzt Instagram, TikTok und Co. heute intensiver als noch im Vorjahr. Doch ein Blick unter die Oberfläche offenbart Risse im digitalen Fundament – und die haben maßgeblich mit dem rasanten Einzug generativer künstlicher Intelligenz (KI) zu tun.

Das KI-Paradoxon: Große Kreationslust, massives Vertrauensproblem

Auf der Creator-Seite ist KI bereits Alltag. 22 Prozent der Befragten haben laut Deloitte schon Bilder per KI erstellt, jeder Zehnte generiert Videos oder Musik. Auch die Zahlungsbereitschaft ist überraschend hoch: Jeder Fünfte wäre bereit, monatlich über 10 Euro für entsprechende Tools auszugeben.

Auf der Konsument*innenseite jedoch kippt die Stimmung bedenklich. Zwei Drittel der Nutzer*innen geben an, dass sie KI-generierte Inhalte im Netz nicht mehr zuverlässig erkennen können. Schlimmer noch: 56 Prozent klagen über eine wachsende Flut an KI-generierten Postings „ohne Mehrwert“ – schlichtweg digitaler Spam. Die Konsequenz dieser Verunsicherung zeigt sich bereits in den Nutzungsdaten: Erste Altersgruppen, insbesondere Nutzer*innen ab Mitte 50, beginnen, ihren Social-Media-Konsum aktiv zurückzufahren.

Die Start-up-Perspektive: Die Zeiten des blinden KI-Hypes sind vorbei. Wer als Gründer*in heute rein quantitativ auf automatisierte Content-Erstellung setzt, riskiert Reichweite und Glaubwürdigkeit. Wie Deloitte-Expertin Sophie Pastowski anmerkt, braucht es dringend „transparente Kennzeichnung, um Vertrauen im digitalen Raum zu stärken.“ Genau hier entsteht ein massiver Zukunftsmarkt für „Trust-Tech“-Start-ups: Werkzeuge, die Authentizität verifizieren, Deepfakes zuverlässig herausfiltern, digitale Wasserzeichen etablieren oder Content-Provenance (Herkunftsnachweise) sichern, werden zu kritischen Erfolgsfaktoren für Plattformen und Verlage.

Streaming-Kollaps: Die Sehnsucht nach dem Super-Aggregator

Auch im Video-Streaming-Markt (SVoD) stehen die Zeichen auf Wandel. Der Markt ist in einer Reifephase angekommen: Zwar verbringen die Deutschen immer mehr Zeit mit Streaming, doch die Abo-Zahlen stagnieren. Mit durchschnittlich 2,5 Abos bei 64 Prozent der Haushalte ist die finanzielle und nervliche Schmerzgrenze offenbar erreicht.