Aktuelle Events

Pitch statt Show Act

Das Pitchen droht mehr und mehr zum Show Act zu verkommen. Es ist an der Zeit, Pitchen genauso strukturiert anzugehen wie andere Aspekte der Unternehmensentwicklung.

In den letzten Jahren habe ich auf den Bühnen Europas gestanden, unzählige Pitches begutachtet und mitgestaltet. Doch leider habe ich dabei beobachtet, wie der eigentliche Zweck des Pitchens – potenzielle Investor*innen oder Kund*innen zu überzeugen – oft in den Hintergrund gerät bzw. das Pitchen zunehmend zu einem Unterhaltungsspektakel verkommt. Statt vor relevantem Publikum zu präsentieren, stehen Start-ups zunehmend vor anderen Start-ups. Ein bedenklicher Trend, der die Wirksamkeit des Pitchens beeinflusst, wenn nicht sogar infrage stellt.

Visitenkarte deiner kommerziellen Fähigkeiten

Was können wir als Start-up-Szene besser machen? Und was können Gründer*innen tun, um die Qualität zu heben und pitchen wieder effektiv zu machen? Meine Beobachtungen zeigen, dass viele Gründer*innen den Pitching-Prozess oft unstrukturiert und unsystematisch angehen. Statt einer methodischen Vorgehensweise setzen sie einfach eine neue PowerPoint-Datei auf. Doch der Pitch ist mehr als nur eine Präsentation – er ist die Visitenkarte deines Start-ups und deiner kommerziellen Fähigkeiten. Es ist also an der Zeit, Pitchen genauso strukturiert anzugehen wie andere Aspekte der Unternehmensentwicklung.

Die im Internet verfügbaren Ressourcen bieten dazu aber leider allzu oft nur oberflächliche Hilfe. Best-Practice-Angebote sowie Tipps und Tricks sind zwar nützlich, aber nicht universell anwendbar. Zudem führen Event-based Coachings von selbsternannten Gurus oft zu kurzfristigen Verbesserungen, anstatt langfristig die persönlichen Kompetenzen der Gründer*innen zu stärken.

Die Kunst, andere zu begeistern

Es ist also an der Zeit, Pitchen als Fähigkeit zu betrachten, die geübt, entwickelt und verfeinert werden kann. Denn letztlich geht es beim Pitchen nicht nur um die Präsentation von Slides, sondern um die Kunst, andere von einer Vision zu begeistern. Die folgenden drei Grundregeln können dir dabei helfen.

1. Überzeuge mit deinem Ziel vor Augen

Als leidenschaftlicher Entrepreneur habe ich in meiner Karriere einen entscheidenden Fehler begangen: Ich war scharf darauf, auf jeder Bühne zu stehen, die sich mir bot. Zwar konnte ich viele Wettbewerbe und Events gewinnen, doch im Vergleich zu anderen Gründer*innen blieb mein geschäftlicher Erfolg oft hinter meinen Erwartungen zurück. Rückblickend erkannte ich, dass ich meinen Fokus verloren hatte. Ich war zu sehr darauf bedacht, auf Veranstaltungen präsent zu sein, zu „mingeln“, ohne zu hinterfragen, was mir das eigentlich bringen würde. Diese Einsicht führte mich zu zwei wichtigen Fragen:

- Was ist eigentlich der Zweck eines Pitches?

- Warum pitchen wir Gründer*innen überhaupt?

Ein Pitch ist – wie erwähnt – mehr als nur eine PowerPoint-Präsentation. Es geht darum, eine Idee nicht nur zu erklären, sondern andere davon zu begeistern und zur Unterstützung zu bewegen. Ein guter Pitch beruht genau aus diesem Grund weniger auf Fakten als auf Visionen und Emotionen. Er ist eine Einladung, sich einer Vision anzuschließen sowie sich aktiv einzubringen und hat daher auch keine universelle Form oder gar Vorlage, sondern variiert je nach Idee, Branche, Gelegenheit, Phase und Kontext.

Ein Pitch bietet eine hervorragende Gelegenheit, Unterstützende zu gewinnen, sei es als Kund*innen, Investor*innen oder strategische Partner*innen. Es ist jedoch wichtig zu verstehen, wen man eigentlich begeistern möchte. Denn jede(r) Zuschauer*in hat eine andere Rolle und kann auf unterschiedliche Weise zum Erfolg des Start-ups beitragen. Überlege dir also vorher, welche Ziele du verfolgst, und wie der nächste Pitch dazu beitragen kann. Überlege dir auch, wen du dazu mit deinem nächsten Pitch erreichen musst, und ob dies bei der Veranstaltung oder im gebotenen Kontext überhaupt möglich ist. Sind diese Voraussetzungen nicht gegeben, dann pitche nicht.

Ein(e) Investor*in sucht beispielsweise nach Projekten für seinen/ihren Venture-Capital-Fonds, während ein(e) Innovationsmanager*in aus einem Konzern nach neuen Technologien oder Lösungen für spezifische Probleme sucht. Ein Pitch zielt darauf ab, die richtigen Personen zu erreichen und sie von der Vision deines Start-ups zu überzeugen, sodass sie dann zu deinen Zielen beitragen. Die Kunst des Pitchens erstreckt sich daher über verschiedene Formen und Kontexte. Ob auf einer Bühne vor einem Publikum oder in einem informellen Gespräch im Aufzug – der Zweck bleibt stets derselbe: andere von einer Vision zu begeistern und Unterstützung zu gewinnen.

2. Entwickle deine Storyline vor deinen Slides

Bevor du in die Planung des Pitches eintauchst, solltest du diese Erkenntnisse berücksichtigen:

- Authentizität spielt eine zentrale Rolle.

- Warum du etwas tust, ist bedeutsamer als was du tust.

Authentizität in einem Pitch bedeutet, dass dein Auftritt zur Kulisse passt. Dies umfasst sowohl das visuelle (deine Slides) als auch das auditive Element (deinen Text). Die Umgebung, die du nicht vollständig kontrollieren kannst, trägt ebenfalls zur Wahrnehmung bei. Authentisch ist die Wahrnehmung des Publikums dann, wenn alles zusammenpasst. Ist deine Geschichte zu gut, um wahr zu sein – sprich: du erzählst Märchen –, ist das meist nicht authentisch. Dasselbe gilt, wenn du fehl am Platz wirkst. Ob du dich bei einer Veranstaltung wohl fühlst, spielt also auch eine Rolle. Simon Sineks Prinzip des Goldenen Kreises betont zusätzlich, dass Menschen nicht kaufen, was du tust, sondern warum du es tust. Dein persönliches Warum ist also entscheidend für die Authentizität deines Pitches.

Eine Geschichte zu erzählen, ist effektiver als bloße Fakten zu präsentieren. Trotzdem werden bestimmte Inhalte in Pitches erwartet oder gar verlangt. Es ist daher sehr verlockend, bei der Erstellung mit den Slides und deren Inhalten anzufangen. Das wäre aber ein großer Fehler. Deine Überzeugung kommt nämlich nicht von deinen Slides, sondern von dir und deiner Story. Konzentriere dich also zunächst darauf, eine authentische Storyline zu entwickeln. Eine gute Pitch-Storyline umfasst üblicherweise folgende fünf Phasen: 1. Eindruck, 2. Relevanz, 3. Vorteil, 4. Vertrauen und 5. Beitrag.

Jede dieser Phasen beantwortet eine Frage, die sich das Publikum zu einem gewissen Zeitpunkt implizit stellt. Jede Phase vermittelt also eine bestimmte Botschaft.

Deine Authentizität sollte in der gesamten Geschichte berücksichtigt werden. Das Warum wird am besten in der Phase der Relevanz platziert. Diese Phase ist auch der ideale Moment, um die Problem-Idee-Lösungs-Kette zu präsentieren. Du machst deutlich, warum deine Idee relevant ist, indem du das Problem, das du lösen möchtest, klar definierst und deine Lösung darlegst.

Wenn du alle fünf Phasen berücksichtigst, kannst du eine kohärente und überzeugende Erzählung gestalten, die nicht nur die Erwartungen erfüllt, sondern auch das Vertrauen und das Interesse deines Publikums gewinnt.

3. Verbessere dich systematisch und kontinuierlich

Der Pitch, oder besser deine Pitch-Kompetenz, ist wie jede andere Fähigkeit: Er bzw. sie muss trainiert werden. Erfolg beim Pitchen ist keine Sache des reinen Talents, sondern eine Kombination aus Begabung und hartem Training. Wenn du also eine(n) Gründer*in siehst, der/die beim Pitchen alle beeindruckt, handelt es sich bei dieser Person selten um ein Naturtalent. Es steckt vielmehr sehr viel Übung dahinter.

Eric Ries, der Silicon-Valley-Entrepreneur und Begründer der Lean-Startup-Methode, propagiert den Kreislauf von „Bauen – Messen – Lernen“. Man baut etwas, misst den Erfolg und lernt aus den Ergebnissen. Dann beginnt man von vorne. Es ist im Grunde eine Methode der kontinuierlichen Verbesserung durch Iteration, aber viel einfacher als herkömmliche Qualitätsmanagementansätze.

Beim Pitchen funktioniert es nicht anders. Du planst einen Pitch, führst ihn durch und vergleichst dann Planung und Durchführung, um Verbesserungspotenzial zu erkennen. Um diese Systematik für deine persönliche Entwicklung zu nutzen, musst du aber zwei Themen berücksichtigen.

Zunächst musst du dazu übergehen, deine Pitches zu planen. Dein Ergebnis kannst du nur beurteilen, wenn du eine Planung hast, mit der du es vergleichen kannst. Was willst du machen versus was hast du gemacht, und wie hat das gewirkt? Für eine optimale Planung solltest du dir die Technik des Scriptings aneignen. Dabei schreibst du einen ganzen Text nieder und brichst ihn in einzelne Statements herunter. Machst du das in einer Tabelle, lassen sich dabei auch noch das Timing und die Interaktionen berücksichtigen. Nun hast du einen Plan – nicht mehr und nicht weniger. Du musst den Text weder auswendig lernen noch dich zu 100 Prozent an ihn halten. Das wirkt meist ohnehin nicht besonders authentisch. Aber einen Plan zu haben, ist schon mal ein guter Schritt in Richtung systemisches Erreichen deiner Ziele.

Um deine Pitching-Fähigkeiten zu verbessern, musst du außerdem wissen, wie du während des Pitches wirkst. Wenn du auf der Bühne stehst, ist es nur schwer zu erkennen, wie das Publikum reagiert. Du bist so darauf konzentriert, deinen Pitch gut durchzuführen, dass du kaum Ressourcen hast, um auf die Reaktionen des Publikums zu achten. Deswegen ist es wichtig, dass du deine Pitch-Auftritte aufzeichnest, egal ob bei einer Übung oder wenn es um die sprichwörtliche Wurst geht. Videoaufnahmen sind besonders hilfreich, da du sie später analysieren kannst. Auch wenn dies anfangs ungewohnt ist, wird es dir garantiert helfen, dich kontinuierlich zu verbessern.

Diese Grundregeln können dir helfen, deine Pitches effektiver zu gestalten und dein Publikum zu überzeugen. Halte dich an diese Richtlinien, um deine Pitch-Fähigkeiten zu verbessern und deine Ziele erfolgreich zu erreichen. Durch die klare Strukturierung deiner Präsentation und die Fokussierung auf deine Story wirst du in der Lage sein, dein Publikum zu begeistern und deine Ideen erfolgreich zu vermitteln.

Tipp zum Weiterarbeiten: Profunde Insights zum Thema Pitchen enthält das neue Fachbuch des Autors dieses Beitrags: Jasper Ettema, 1M€ Pitching – Pitch Development für Entrepreneurs & Innovators. Das Buch ist exklusiv verfügbar auf www.1m-pitching.com bzw. www.milliondollarpitching.com

Diese Artikel könnten Sie auch interessieren:

Produktivität statt Überstunden: Wie Echtzeitdaten das Finanzwesen von morgen steuern

Das KI-gestützte Fintech Embat beendet das Excel-Chaos im Treasury und macht Finanzteams mit Echtzeitdaten fit für die Zukunft.

Berlin, 28. April 2026 – Es ist ein bekanntes Bild in den Finanz- und Treasury-Abteilungen des deutschen Mittelstands: Wenn der Monatsabschluss naht oder Ad-hoc-Berichte für die Geschäftsführung benötigt werden, bleiben die Schreibtischlampen bis spät in die Nacht an. Die manuelle Zusammenführung von Daten aus unterschiedlichen Bankportalen und historisch gewachsenen Excel-Listen kostet nicht nur Nerven, sondern vor allem wertvolle Zeit.

Das schnell wachsende Fintech Embat tritt an, um genau diesen Engpass aufzulösen. André Reimers, Head of DACH, treibt diese Mission im deutschsprachigen Raum als Gesicht des Unternehmens voran. Seine Kernüberzeugung: Wer heute noch regelmäßig Überstunden machen muss, um finanzielle Transparenz zu schaffen, leidet nicht unter mangelnder Einsatzbereitschaft – er leidet unter einem strukturellen Datenproblem.

Beeindruckendes Wachstum durch das Lösen echter Pain Points

Dass der Schmerz in den Finanzabteilungen groß und der Bedarf an modernen Lösungen riesig ist, belegen die Zahlen, mit denen Embat den europäischen Markt aufrollt. Mit einem starken Kundenwachstum im deutschen Markt von über 250 Prozent im vergangenen Jahr und mittlerweile mehr als 400 mittelständischen und großen Unternehmenskunden weltweit hat sich das Fintech als fester Player etabliert. Das stetig wachsende Transaktionsvolumen von 250 Millionen Euro zeigt deutlich: Der Wechsel von fehleranfälligen Tabellen zu automatisierten Cloud-Lösungen ist in vollem Gange.

Der Weg aus der Excel-Falle

Mit seiner Technologie nimmt Embat den Kampf gegen ineffiziente Prozesse im Treasury auf. Anstatt hochqualifizierte Mitarbeiter mit repetitiver Datenpflege zu binden, automatisiert das System die Konsolidierung aller relevanten Finanzdaten.

„Die Erwartungshaltung, dass komplexe Finanzanalysen zwingend mit langen Abenden im Büro einhergehen müssen, ist schlichtweg nicht mehr zeitgemäß“, erklärt André Reimers. „Wenn Cashflow, Liquidität und Runways per Knopfdruck in Echtzeit abrufbar sind, ändert sich die gesamte Arbeitsdynamik. Finanzteams können aus dem reaktiven Modus heraustreten und sich auf die strategische Steuerung des Unternehmens konzentrieren.“

Hohe Innovationskraft trifft auf lokales DACH-Verständnis

Embat profitiert von einer enormen Innovationsgeschwindigkeit und Agilität, auf der die starke technologische Basis des Unternehmens beruht. Wie diese passgenau auf die spezifischen Bedürfnisse des deutschen Marktes übersetzt wird und für eine hohe lokale Marktpräsenz sorgt, zeigt André Reimers an den Standorten in München und Berlin.

Von diesen beiden Standorten aus steuert André Reimers das DACH-Geschäft und stellt das tiefe Verständnis für die komplexen Strukturen und hohen Sicherheitsbedürfnisse des deutschen Mittelstands sicher. Das Team zeigt dabei, wie moderne, dezentrale Zusammenarbeit erfolgreich funktioniert. Das Vertrauen der stetig wachsenden deutschen Kundenbasis fußt dabei auf dieser geballten lokalen Expertise gepaart mit der unerschütterlichen Zuverlässigkeit der Systeme.

Führen durch Resultate, nicht durch Anwesenheit

Die Botschaft an die Finanzwelt ist klar: Moderne Führung, hohe Produktivität und Skalierbarkeit erfordern keine starren Kontrollmechanismen oder endlosen Arbeitstage. Sie erfordern radikale Datentransparenz und die richtigen digitalen Werkzeuge. Wenn die Daten in Echtzeit fließen, sinkt die Fehlerquote, die Entscheidungsgeschwindigkeit steigt – und die systembedingten Überstunden im Treasury gehören endgültig der Vergangenheit an.

Über Embat:

Embat ist ein KI-gestütztes FinTech mit Schwerpunkt auf Treasury-Management, das es mittelständischen Unternehmen und Großkonzernen ermöglicht, ihre Finanzprozesse in Echtzeit zu zentralisieren. Gegründet von Antonio Berga und Carlos Serrano – ehemaligen J.P. Morgan-Managern mit umfassender Erfahrung im Corporate Banking – sowie Tomás Gil, dem ehemaligen CTO von Fintonic, entstand die Plattform mit der Mission, die Finanzabteilung zu digitalisieren. Die klare Prämisse dabei: Technologie von Finanzexperten für Finanzexperten.

Durch seine hybride Konnektivität lässt sich Embat in über 15.000 Banken und führende ERP-Systeme integrieren und beseitigt so jegliche Datenfragmentierung. Das wichtigste Alleinstellungsmerkmal ist TellMe, ein „Agentic Treasury Analyst“ (autonomer KI-Analyst), der Cashflow-Muster erkennt, komplexe Kontenabstimmungen automatisiert und strategische Entscheidungen zur Optimierung der Liquidität vorschlägt.

Mit Niederlassungen in Madrid, London, Berlin und München definiert Embat die Zukunft des Corporate Finance neu.

Bootstrapping im LegalTech: Wie cleverklagen den Arbeitsrechtsmarkt aufmischt – und wo die Grenzen des Modells liegen.

LegalTech-Start-ups versprechen den niederschwelligen Zugang zum Recht. Das 2020 von Fabian Beulke und Lucas Rößler gegründete cleverklagen fokussiert sich dabei auf das Arbeitsrecht und will Arbeitnehmer*innen bei Kündigungen sowie Abfindungen unterstützen. Die Besonderheit: Das Gründer-Duo wächst im Gegensatz zu vielen Wettbewerber*innen profitabel und das gänzlich ohne Investor*innen. Doch in einem hart umkämpften Markt stellt sich die Frage, wie nachhaltig das provisionsbasierte Geschäftsmodell und der technologische Vorsprung wirklich sind.

Der Markt für verbraucherorientiertes LegalTech (B2C) hat in den vergangenen Jahren in Deutschland stark an Fahrt aufgenommen. Im Zentrum stehen oft standardisierbare Massenverfahren – von Fluggastrechten über Mietminderungen bis hin zum Arbeitsrecht. In letzterem Segment positioniert sich cleverklagen.

Bootstrapping in einem teuren Markt

Gegründet wurde die Plattform im Jahr 2020 von den beiden Rechtsanwälten Fabian Beulke und Lucas Rößler. Die Idee entstand in ihrer gemeinsamen Zeit bei der renommierten Kanzlei Hausfeld LLP, wo sie maßgeblich in die Betreuung großer Sammelklagen involviert waren. Diese Erfahrung inspirierte das Duo zu einem Ansatz, den sie selbst als eine Art „Robin Hood Litigation“ beschreiben: Sie wollen die strukturellen Nachteile von Arbeitnehmer*innen gegenüber ressourcenstarken Unternehmen ausgleichen. Dabei positioniert sich das Start-up bewusst als moderne Alternative zur klassischen Kanzlei.

Bemerkenswert für die Start-up-Szene: cleverklagen wächst seit der Gründung profitabel und verzichtet dabei vollständig auf externes Kapital. Das ist mutig. Denn im B2C-Arbeitsrecht haben Kund*innen einen extrem niedrigen Lifetime Value – man wird idealerweise nur einmal gekündigt –, während die Akquisekosten via Google Ads enorm sind. Wie stemmt man das gegen VC-finanzierte Konkurrenz?

„Wir haben bewusst klein angefangen“, blickt Lucas Rößler zurück. „Gerade beim Bootstrapping kommt es darauf an, extrem effizient und genau zu arbeiten. Denn wenn das Geld knapp ist, kann man sich nur wenige Fehler leisten“, erinnert er sich an die harte Anfangsphase, in der das Duo nahezu alles selbst übernehmen musste. Fehlerverzeihlich ist das B2C-Arbeitsrecht bis heute nicht: Wer im Google-Ads-Wettbewerb gegen VC-finanzierte Player antritt, braucht Nerven aus Stahl – und, wie Rößler anmerkt, „einen starken Sales-Funnel, von der Anzeige bis zur Conversion“. Neben dieser technischen Präzision brauche es laut dem Gründer aber auch „sehr viel Liebe fürs Detail und ein gutes Verständnis, was die Kund*innen von einem erwarten“. Ob sich ein(e) einzelne(r) Mandant*in rechne, müsse man in der Summe betrachten. Dank erfahrener Anwält*innen sei man meist erfolgreich, was dem Unternehmen heute eine finanzielle Stabilität gebe, die in der Anfangsphase gefehlt habe.

Prozesskostenfinanzierung statt Stundenlohn

Die Geschäftsidee verknüpft digitale Prozessabläufe mit der Betreuung durch echte Jurist*innen. Eine eigens entwickelte Software soll Arbeitsabläufe vereinfachen und dem Team mehr Raum für die Mandant*innenbetreuung geben. Das Kernstück ist jedoch das finanzielle Modell, das einer klassischen Prozesskostenfinanzierung entspricht: Es gibt kein Vorkostenrisiko und im Falle einer Niederlage entstehen den Arbeitnehmer*innen keine Kosten. Verfügen die Kund*innen über keine Rechtsschutzversicherung, finanziert cleverklagen den Prozess vor. Im Gegenzug wird eine Provision fällig, die als Teil der zusätzlich ausgehandelten Abfindung beschrieben wird.

Doch wie hoch ist diese Erfolgsprovision genau? „Unsere Erfolgsprovision ist bewusst nicht einheitlich festgelegt, sondern hängt immer vom jeweiligen Fall ab“, erklärt Fabian Beulke. Man berücksichtige das Verlustrisiko, die übernommenen Anwaltskosten und die realistische Abfindungshöhe. „Durchschnittlich kann man sagen, dass unser Erfolgshonorar bei knappen 30 Prozent liegt“, präzisiert Beulke. Stehe eine sehr hohe Abfindung im Raum, könne die Provision auch deutlich darunter fallen – bei hohem Risiko aber auch entsprechend steigen.

Während sich das Duo bei der Erfolgsquote auskunftsfreudig zeigt – derzeit schließe man über 90 Prozent der Fälle erfolgreich ab und wachse jährlich um rund 50 Prozent –, mauern die beiden bei der Frage nach den genauen Finanzen. „Zu konkreten Umsatzzielen äußern wir uns allerdings nicht“, wiegelt Beulke ab.

Das „Rosinenpickerei“-Dilemma

Das Modell der Prozessfinanzierung ist lukrativ, steht bei Kritikerinnen aber oft unter dem Verdacht des sogenannten Cherry-Pickings. Der Vorwurf lautet, Anbieter*innen würden durch Algorithmen rigoros vorfiltern und nur die fast risikolosen Fälle annehmen, während komplexe oder wirtschaftlich kleinere Schicksale durchs Raster fallen.

Lucas Rößler wehrt sich vehement gegen diese Darstellung: „Diese Kritik können wir so nicht bestätigen. Unsere Ablehnungsquote ist sehr niedrig, denn wir wollen so vielen Menschen wie möglich helfen.“ Zwar bleibt Rößler eine exakte Prozentzahl bei der Ablehnungsquote schuldig, verspricht aber: „Uns ist es ganz egal, ob unser(e) Mandant*in Mini-Jobber*in oder eine hochbezahlte Führungskraft ist. Auch komplexere oder risikoreichere Fälle schließen wir nicht aus.“ Abgelehnt werde laut Rößler nur bei Anfragen, die den eigenen moralischen Werten widersprechen – oder „wenn kein Anspruch oder Verhandlungshebel gegen den bzw. die Arbeitgeberin vorliegt“. Robin Hood agiert im LegalTech-Markt eben auch mit wirtschaftlichem Kalkül.

Proprietäre Software vs. Standard-KI

Cleverklagen betont medial gern den Einsatz eigener Tech- und KI-Lösungen. Doch in Zeiten, in denen sich standardisierte juristische Branchen-KIs rasant entwickeln, wird eine eigene Fallbearbeitungs-Software zunehmend zum reinen Hygienefaktor und verliert als unüberwindbarer Wettbewerbsvorteil an Strahlkraft.

Wo genau zieht das Start-up also die technische Grenze zwischen Automatisierung und anwaltlichem Handwerk? „Künstliche Intelligenz soll unsere Anwält*innen in erster Linie bei repetitiven und administrativen Aufgaben unterstützen“, ordnet Fabian Beulke ein. Es gehe vor allem um Fristen- und Aufgabenmanagement, Terminplanung oder die Dokumentenverwaltung. Dabei setze man auf hohe Datenschutzstandards: Die hauseigene KI laufe ausschließlich auf eigenen Servern, gänzlich ohne externe Datenverbindungen. Zudem durchkämme die KI laufend die Akten für Konsistenz-Checks. Ein pragmatischer statt revolutionärer Ansatz, wie Beulke unumwunden zugibt: „Das ist wichtig, damit bei der Vielzahl laufender Fälle nichts daneben geht.“

Bei der juristischen Kernarbeit zieht Beulke jedoch eine klare rote Linie: „Uns ist wichtig, dass eine Entscheidung nie von der KI getroffen wird. Diese Verantwortung liegt ausschließlich bei unseren Anwält*innen.“ Gerade das Arbeitsrecht sei viel Verhandlungssache, die oft mündlich in persönlichen Gesprächen oder vor Gericht geklärt werde. „Es braucht ein starkes Verhandlungsgeschick, Erfahrung und das richtige Timing“, so der Mitgründer. „Das kann KI aus unserer Sicht nicht ersetzen.“

Fazit & Ausblick

Cleverklagen zeigt eindrücklich, dass gesundes Wachstum ohne Investorinnen auch im anwaltlichen Dienstleistungssektor funktionieren kann. Die eigentliche Herausforderung für das Duo dürfte künftig jedoch weniger in der hauseigenen Softwareentwicklung liegen, sondern in der profitablen und skalierbaren Kund*innenakquise.

Wo sieht sich das Unternehmen in zwei Jahren? Lucas Rößler hat klare finanzielle Ambitionen: „Wenn weiterhin alles gut läuft, haben wir unseren Umsatz und Gewinn in zwei Jahren idealerweise mehr als verdoppelt.“ Ob man die vertikale Marktführerschaft im Arbeitsrecht erzwingen könne, werde sich zeigen.

Interessant ist jedoch die strategische Ausrichtung für die Zukunft: Cleverklagen plant die Expansion in weitere Rechtsgebiete. Dabei wolle man sich explizit nicht auf standardisierte Massenverfahren fokussieren, verrät Rößler: „Wir wollen Rechtshilfe in Bereichen bieten, in denen Menschen echte und oft existenzielle Unterstützung benötigen. Zum Beispiel bei Streitigkeiten mit Versicherungen oder bei familien- oder erbrechtlichen Fragen.“

KI-Baukasten für den Mittelstand: Kann firepanda.ai das Versprechen der Einfachheit halten?

Das Münchner Start-up firepanda.ai launcht neue Plattform-Features und ein überarbeitetes Preismodell. Mit prominenter Gründer-Erfahrung aus E-Commerce und IT will das Unternehmen den DACH-Mittelstand erobern. Doch wie zukunftssicher ist der Spagat zwischen Orchestrierung und „KI-Steuer“?

Die Integration künstlicher Intelligenz gleicht in vielen mittelständischen Betrieben aktuell noch einem Blindflug. Es fehlen oft Ressourcen für komplexe Implementierungen oder das Know-how zur Einhaltung von Datenschutzstandards. Genau in diese Lücke stößt die Münchner All-in-One-Plattform firepanda.ai. Was im Jahr 2022 als direkte Reaktion auf den globalen „ChatGPT-Moment“ innerhalb eines IT-Entwicklungsbüros begann, will mit einer aktualisierten Plattformversion den Marktzugang für den Mittelstand nun endgültig vereinfachen.

Vom „ChatGPT-Schock“ zum Agentur-Spin-off

Die Geschichte von firepanda.ai nahm ihren Lauf, als die Veröffentlichung von ChatGPT die Tech-Welt erschütterte. In der Münchner IT-Agentur Fireflow erkannten die Gründer sofort den massiven Bedarf – und die gleichzeitige Verunsicherung – bei ihren Kund*innen. Statt den Trend nur zu beobachten, entwickelte das Team in intensiven Konzeptionsphasen eine Lösung, die den deutschen Mittelstand sicher in das KI-Zeitalter führen soll. Anfang 2025 erfolgte dann der offizielle Launch.

Hinter diesem Spin-off stehen zwei Köpfe mit komplementären Profilen. Dr. Peter Dornbusch (CEO & CTO) ist promovierter Informatiker und DeepTech-Veteran mit über 25 Jahren IT-Erfahrung. Flankiert wird er von Daniel Kövary, einem Experten für Business Development und digitale Markenführung.

Auf die Frage, wie schwer der Spagat zwischen anspruchsvollem Agenturgeschäft und der Inkubation einer völlig neuen SaaS-Plattform war, räumt Kövary ein: „Es war zweifellos ein enormer Kraftakt, der sich jedoch als unser größter strategischer Vorteil erwies.“ Durch das Tagesgeschäft sei man extrem nah an den realen Schmerzpunkten der Kund*innen – wie Datenschutzbedenken und Ressourcenmangel – gewesen. Die lange Entwicklungszeit bis 2025 war dabei eine bewusste Entscheidung gegen schnelle halbe Sachen. „Wir wollten keine weitere dünne ‚Wrapper-App‘ auf den Markt bringen“, betont Kövary und fügt hinzu: „Durch KI-gestütztes Coding haben wir eine echte Zeitenwende erlebt und unsere Entwicklungszyklen bei herausragender Code-Qualität massiv verkürzt.“

Schluss mit dem KI-Flickenteppich

Die Kernidee von firepanda.ai ist ein modellagnostisches KI-Backend, das Nutzer*innen flexibel zwischen den Modellen von Anbietern wie OpenAI, Anthropic oder Google wählen lässt, ohne separate Verträge abschließen zu müssen. Ein entscheidender Hebel für den Vertrieb ist dabei die Datensicherheit, da die Plattform auf Servern in Deutschland gehostet wird.

Doch wie garantiert das Start-up rechtssicher, dass Daten bei der Nutzung von OpenAI nicht vom US-Cloud Act erfasst werden? Dr. Peter Dornbusch gibt sich hier kompromisslos: „Um höchste Datenschutzstandards zu gewährleisten, routen wir Anfragen an Modelle wie OpenAI nicht über die Standard-US-Schnittstellen, sondern ausschließlich über DSGVO-konforme Instanzen etablierter Anbieter wie Microsoft Azure oder AWS, die in Europa gehostet werden.“ Dabei würden strikte Zero-Data-Retention-Policies greifen, die verhindern, dass Kund*innendaten für das Modell-Training genutzt werden. Für Unternehmen mit extrem restriktiven Vorgaben bietet firepanda.ai zudem europäische Open-Source-Modelle wie Mistral an, die autark in Deutschland gehostet werden. „Der Kunde ist nicht in einem System gefangen, sondern behält die volle Souveränität“, resümiert der CTO.

KI-Agenten per Drag-and-drop

Um ohne Programmierkenntnisse spezifische KI-Assistenten zu konfigurieren, bietet die Plattform einen Workflow-Builder an, in dem/der Nutzer*in Trigger und Aktionen per Drag-and-drop verknüpfen.

Trotz dieser Versprechen mutieren viele B2B-Start-ups oft zu Beratungsagenturen, weil Kund*innen das Self-Serve-Prinzip nicht allein bewältigen. Daniel Kövary kennt dieses Problem: Die Wucht der Technologie überfordere aktuell noch viele Organisationen. Während globale Player wie Anthropic massiv gegensteuern und sogenannte Forward Deployed Engineers einsetzen, die Use Cases direkt in Unternehmen auf eigene Kosten umsetzen, wählt das Münchner Team einen anderen Pfad. „Da wir diesen extrem ressourcenintensiven Weg weder gehen können noch wollen, lautet unsere strategische Antwort: Enablement!“, stellt Kövary klar. Statt klassischem Handholding setzt man auf ein mehrstufiges Befähigungsmodell im Produkt – von abteilungsspezifischen Prompt-Bibliotheken für Anfänger*innen bis zum Workflow-Builder für Profis. Das Versprechen des Gründers: „Unser primäres Ziel im Onboarding ist es, unternehmensinterne ‚KI-Champions‘ auszubilden, die das Wissen als Multiplikatoren eigenständig skalieren.“

Transparenter Deal oder teure Skalierung?

Seit dem 1. März 2026 lockt firepanda.ai mit einer kostenlosen Testversion inklusive einer Million Token. Im produktiven Einsatz werden 19,95 Euro pro Nutzer*in im Monat fällig, während die Token-Kosten mit einem Handling-Aufschlag von zehn Prozent transparent weitergereicht werden. Zusatzmodule kosten extra: 395 Euro für Workflow-Automatisierung und 95 Euro für API-Anbindungen.

Bislang ist das Start-up komplett bootstrapped. Um die Infrastrukturkosten und die geplante Skalierung zu stemmen, sucht das Unternehmen nun aber sehr selektive Seed-Finanzierungen. Dornbusch sucht dabei explizit nicht nach klassischem Venture Capital, sondern nach „Smart Money“ von strategischen Business Angels. Das ehrgeizige Ziel: „Unser Meilenstein bei diesem kontrollierten Wachstum ist es, durch die anstehende Skalierungsphase bis Ende 2026 den Break-even zu erreichen.“

Die „KI-Steuer“-Falle und wartende Tech-Giganten

Kritiker*innen könnten den zehnprozentigen Token-Aufschlag bei hohen Datenmengen als kostspielige „KI-Steuer“ ansehen, was zur Abwanderung Richtung Direkt-APIs führen könnte. Zudem buhlen globale Wettbewerber wie Make.com oder Microsofts Copilot Studio um den Mittelstand.

Dornbusch wehrt sich gegen den Begriff der Steuer: „Wir sehen diesen zehnprozentigen Aufschlag keineswegs als ‚KI-Steuer‘, sondern als nachvollziehbare Service-Fee.“ Diese Marge decke die komplexe Orchestrierung sowie Compliance-Sicherheit ab und erspare mühsames Vertragsmanagement. Dass Kund*innen bei steigendem KI-Reifegrad abwandern, glaubt er nicht: „Wenn ein Unternehmen erst einmal komplexe Freigabeschleifen, RAG-Pipelines mit proprietären internen Daten und externe API-Trigger in firepanda.ai modelliert hat, wechselt es nicht wegen eines marginal günstigeren Token-Preises die Plattform.“

Und was passiert, wenn Microsoft seinen Copilot so tief integriert, dass externe KMU-Layer überflüssig werden? Kövary kontert, dass Copilot zwar gut für persönliche Produktivität sei, die reale Prozesslandschaft des Mittelstands aber weitaus komplexer. „Wir müssen aufhören, diesen Layer als dünne, überflüssige Benutzeroberfläche zu missverstehen – er ist vielmehr das schützende Betriebssystem eines jeden Unternehmens in der KI-Ära“, argumentiert er. Durch diese Architektur befreie man Kund*innen aus dem Vendor-Lock-in einzelner Großkonzerne.

Genialer Eisbrecher mit Ablaufdatum?

Für die ersten 12 bis 24 Monate der KI-Transformation ist firepanda.ai als technologischer Eisbrecher hochattraktiv. Langfristig muss sich allerdings zeigen, ob die eigenen Workflow-Logiken stark genug sind, um gegen die Marktmacht der großen Ökosysteme zu bestehen.

Gefragt nach der Zukunft und einem möglichen Exit winkt Dr. Peter Dornbusch ab. Die Backend-Entwicklung sei dank 20 Jahren Agenturerfahrung keine Hürde gewesen, sondern der größte strategische Hebel, um eine sichere Enterprise-Umgebung zu schaffen. Man sei gekommen, um zu bleiben: „Ein schneller Exit ist nicht unser Fokus, denn der europäische Markt für B2B-KI steht erst ganz am Anfang“, stellt der CTO klar und gibt die zukünftige Marschroute vor: „Wir bauen hier an einem nachhaltigen und unabhängigen ‚German AI Champion‘, der dem Mittelstand dauerhaft hilft, seine Produktivität messbar und zukunftssicher zu steigern.“

Fahrfuchs: Kein Führerschein, aber das Auto neu gedacht

Die Gründer Florian Ritzel und Jannik Kirchhoff aus Hamburg wollen das Problem der versteckten Autokosten lösen. Ihre App Fahrfuchs kletterte ohne Marketingbudget in die Top 100 der Finanz-Charts im App Store – eine klassische Bootstrapping-Erfolgsgeschichte. Doch wie tragfähig ist das Geschäftsmodell, wenn etablierte Konkurrenten den Markt beherrschen?

Während andere Abiturient*innen für Klausuren büffeln, programmierten Florian Ritzel und sein Mitgründer Jannik Kirchhoff (beide 18) ein Start-up. Die Initialzündung war laut den beiden Hamburger Gymnasiasten eine gesellschaftliche Beobachtung: Die Belastung durch Mobilitätskosten. „Die alleinerziehende Mutter sollte nicht an der Zapfsäule stehen müssen und entscheiden, ob sie ihr Kind in die Kita oder sich selbst zur Arbeit fährt“, beschreibt Ritzel die Motivation hinter dem Projekt. Die amüsante Ironie ihrer Gründung: Die Fahrfuchs-Gründer besitzen aktuell nicht einmal einen Führerschein.

Auf die naheliegende Skepsis bezüglich dieses fehlenden „Nutzer-Wissens“ reagiert Florian Ritzel offensiv: „Natürlich gibt es immer Leute, die unsere Idee kritisieren. Und fehlendes Nutzerwissen ist gerade am Anfang schwierig, vor allem, wenn man eine App bauen möchte, die möglichst vielen Menschen hilft.“ Doch aus der vermeintlichen Schwäche machten sie eine Stärke durch maximale Nutzerorientierung. „Wir haben bereits vorher im Umfeld rumgefragt, was die Leute eigentlich brauchen, und danach gezielt um Feedback gebeten“, erklärt der Gründer. Der Erfolg gibt ihnen recht: „Inzwischen erreichen uns täglich dutzende Mails mit Tipps – was die Nutzer*innen sich wünschen und wie wir die App verbessern können. Dadurch wird uns das Ganze nicht zum Verhängnis, sondern sogar zum Vorteil.“

Mit Fahrfuchs wollen sie den rund 48,5 Millionen Pkw-Halter*innen in Deutschland auf den Cent genau aufzeigen, wo das Auto wirklich Geld frisst. Denn der teure Kraftstoff ist nur ein Teil der Wahrheit. Falsche Versicherungstarife, unbemerkter Wertverlust, Wartung und vergessene Pendlerpauschalen reißen oft weitaus größere Löcher ins Budget. Die Resonanz ist für die frühe Phase beachtlich: Ganz ohne bezahltes Marketing sammelte die App schnell über 700 Downloads ein – eine für den Massenmarkt zwar noch bescheidene Zahl, die jedoch ausreichte, um mehrfach in die Top 100 der Finanz-Charts im App Store zu stürmen. Zudem generierte das Projekt rein organisch Presseberichte, unter anderem in der FAZ, der SWP und bei Antenne Bayern.

Holistischer Ansatz statt reiner Tank-App

Auf den ersten Blick wirkt Fahrfuchs wie ein weiterer Spritpreis-Radar. Die App zieht in Echtzeit Daten der Markttransparenzstelle für Kraftstoffe, listet Ladesäulen für E-Autos und alarmiert per Push-Nachricht bei günstigen Preisen. Der entscheidende Pivot ist jedoch das ganzheitliche Kostentracking: Die Gründer haben einen eigenen Versicherungsrechner sowie einen Steuer-Sparrechner integriert, bieten detaillierte Monatsreports an und binden die Nutzer*innen über einen Gamification-Ansatz („Sparfuchs-Score“). Ein zentrales Versprechen in Zeiten von Datenskandalen: Alle sensiblen Nutzer*innendaten werden lokal auf dem Endgerät gespeichert – es gibt keine zentrale Cloud.

Angesprochen auf die Skalierbarkeit dieses Modells bezieht Jannik Kirchhoff klar Stellung: „Die lokale Datenspeicherung ist gerade in Deutschland kein strategisches Eigentor. Ich halte nichts für wichtiger, als die privaten Daten unserer Nutzer*innen zu schützen“. Er warnt vor den Risiken zentraler Speicherlösungen: „Niemand muss wissen, wo ich wohne, wohin ich morgens fahre oder wo meine Kinder zur Kita gehen. Wir haben in der Vergangenheit immer wieder gesehen, dass jeder gehackt werden kann. Und gerade als junge Entwickler können und wollen wir diese Verantwortung nicht übernehmen“. Personalisierte Spar-Vorschläge ließen sich laut Kirchhoff auch direkt auf dem Smartphone „hervorragend realisieren“.

Ein echtes Haifischbecken

Die Vision ist ambitioniert, doch der Markt ist hart umkämpft. Die Konkurrenz reicht von Excel-Tabellen bis zu Platzhirschen wie Spritmonitor oder Giganten wie Clever Tanken. Warum also wechseln? Florian Ritzel gibt sich selbstbewusst: „Die Spritpreis-Übersicht ist bei uns nur eines von vielen Features – nicht der Hauptteil. Wer Spritmonitor so gut findet, darf dort gerne bleiben.“ Der Fokus liege woanders: „Wer aber wirklich tracken möchte, was sein Auto insgesamt kostet, der kann das eben nur bei uns. Diese Gesamtheit an Features gibt es bisher in keiner anderen App in dieser Form.“ Selbst das Argument der manuellen Excel-Tabelle lässt er nicht gelten: „Natürlich kann man sich das selbst in Excel bauen – aber darauf haben die meisten Leute schlicht keine Lust. Genau deswegen sind wir so gut.“

Kritisch hinterfragt

Trotz des Aufklärungscharakters ist Fahrfuchs kein reines Hobbyprojekt; In-App-Käufe für eine „Plus“-Version (0,99 €/Monat) sowie eine „Pro“-Version (2,99 €/Monat bzw. 19,99 €/Jahr) bilden das Monetarisierungsmodell. Ob die selbstgestrickte Mathematik hinter dem Versicherungsrechner, der auf hunderten per Hand durchgerechneten Profilen basiert, ohne echte API-Schnittstellen dauerhaft standhält, bleibt abzuwarten.

Wie viele Abonnent*innen braucht es, um nach dem Abitur davon zu leben? Jannik Kirchhoff rechnet vor: „Ehrlicherweise vermutlich mehr als 10.000 zahlende Abonnent*innen – aber das ist zunächst auch nicht unser Ziel.“ Aktuell stehe das Lernen im Vordergrund: „Wir wollen vor allem Erfahrungen sammeln durch das, was wir machen, und gleichzeitig die laufenden Kosten decken. Das sollte demnächst möglich sein.“

Für die Zeit nach dem Abschluss hält er sich alle Türen offen: „Risikokapital halte ich ab dem Moment für unumgänglich, an dem wir wirklich konkret expandieren wollen. Das wird vermutlich nach dem Abitur der Fall sein. Dann muss man schauen, ob es sich lohnt, Anteile abzugeben oder Kredite aufzunehmen.“ Sein Fazit: „Spannend wird es erst, wenn wir die Idee wirklich groß skalieren wollen.“

Ein exzellentes MVP mit Pivot-Potenzial

Fahrfuchs ist ein Lehrbuchbeispiel für ein hervorragendes Minimum Viable Product (MVP). Um jedoch hochprofitabel zu werden, könnte mittelfristig ein Wechsel hin zur Affiliate-Provision für Versicherungswechsel nötig sein. Doch hier bremst Florian Ritzel bewusst: „Versicherungspartner wollen wir zunächst bewusst nicht werden, denn einer der entscheidendsten Punkte unserer App ist, dass wir Versicherungsdaten unabhängig zur Verfügung stellen.“

Sein Ziel ist technologische Exzellenz: „Meilenstein eins ist, den Versicherungsrechner so akkurat zu machen, dass wir auf Check24-Niveau sind – ohne dafür Provisionen zu kassieren.“ Zudem plane man Kooperationen mit Fahrschulen und Werkstätten, um die Leute genau dort zu erreichen, „wo sie am meisten ans Auto denken“. Die größte Hürde bleibt derweil technischer Natur: „Meilenstein drei ist die Android-Version – das ist allerdings extrem schwer umzusetzen, gerade wenn man iOS-Coding gewohnt ist.“ Dennoch verspricht er: „Wir planen das aber innerhalb der nächsten drei Monate.“

Der Grundstein ist gelegt. Nun müssen die beiden Hamburger beweisen, dass sie nach dem Abitur nicht nur programmieren, sondern auch unternehmerisch durch den dichten Verkehr des Mobilitätsmarktes navigieren können.

MANA: Wie Virtual Office Services den Unternehmensalltag neu strukturieren

Ein detailliertes Portrait von MANA: Virtual Office, digitale Prozesse und persönliche Betreuung für Start-ups und KMU.

Die Arbeitswelt hat sich in den vergangenen Jahren grundlegend verändert. Flexible Arbeitsmodelle, digitale Prozesse und ortsunabhängiges Arbeiten sind längst keine Ausnahme mehr, sondern prägen den Alltag vieler Unternehmen. Gleichzeitig stehen insbesondere Start-ups, Selbstständige und kleine Unternehmen vor der Herausforderung, administrative Aufgaben effizient zu organisieren, ohne dabei wertvolle Ressourcen zu verlieren.

Genau an dieser Schnittstelle setzt MANA an. Das Unternehmen positioniert sich als zentraler Ansprechpartner für organisatorische Prozesse im Hintergrund – mit dem Ziel, den Geschäftsalltag einfacher, strukturierter und digitaler zu gestalten. Weitere Informationen zum Leistungsangebot und zur Struktur des Unternehmens finden sich unter https://we-are-mana.com/.

Von der Idee zur Lösung: Warum MANA entstanden ist

Wer gründet, konzentriert sich zunächst auf Produkt, Markt und Wachstum. Doch schnell wird deutlich, dass administrative Aufgaben einen erheblichen Teil der täglichen Arbeit ausmachen. Posteingang, Dokumentenmanagement oder rechtliche Anforderungen gehören zu den grundlegenden Pflichten – sind jedoch selten der eigentliche Fokus eines Unternehmens.

Gerade in kleinen Teams oder bei Einzelunternehmen entstehen dadurch typische Herausforderungen:

- fehlende Zeit für organisatorische Aufgaben

- unklare Abläufe im Umgang mit Dokumenten

- Unsicherheiten bei rechtlichen Anforderungen

- mangelnde Struktur im Tagesgeschäft

MANA setzt genau hier an und verfolgt einen Ansatz, der diese Prozesse bündelt und vereinfacht. Ziel ist es, Unternehmen von administrativen Aufgaben zu entlasten, ohne dass diese eigene Strukturen aufbauen müssen.

Virtual Office neu definiert

Das Konzept des Virtual Office ist grundsätzlich bekannt, wird jedoch häufig auf die Bereitstellung einer Geschäftsadresse reduziert. MANA erweitert diesen Ansatz um digitale und organisatorische Komponenten, die über klassische Angebote hinausgehen.

Im Zentrum stehen dabei:

- eine ladungs- und handelsregisterfähige Geschäftsadresse

- ein strukturierter Postservice

- digitale Bereitstellung eingehender Dokumente

Alle eingehenden Sendungen werden digitalisiert und online zur Verfügung gestellt – in vielen Fällen noch am Tag des Eingangs. Dadurch entsteht ein jederzeit verfügbarer Überblick über wichtige Unterlagen. Originaldokumente können bei Bedarf zuverlässig weitergeleitet werden.

Diese Kombination ermöglicht es Unternehmen, ortsunabhängig zu arbeiten und gleichzeitig alle formalen Anforderungen zu erfüllen.

Persönliche Betreuung als zentraler Unterschied

Ein wesentliches Merkmal von MANA ist der persönliche Ansatz. Während viele Anbieter auf standardisierte Prozesse und automatisierte Abläufe setzen, legt das Unternehmen Wert auf direkte Ansprechpartner und individuelle Betreuung.

Das zeigt sich insbesondere in:

- persönlicher Kommunikation statt anonymem Support

- festen Ansprechpartnern für individuelle Anliegen

- schnellen und nachvollziehbaren Lösungen

Diese Struktur schafft Vertrauen und sorgt dafür, dass Kunden nicht als Nummer behandelt werden. Gerade für kleinere Unternehmen kann dieser persönliche Kontakt ein entscheidender Faktor sein.

Berlin im Fokus – Expansion in weitere Städte

Der aktuelle Schwerpunkt von MANA liegt auf Berlin. Als einer der wichtigsten Gründerstandorte Europas bietet die Stadt ideale Voraussetzungen für junge Unternehmen und innovative Geschäftsmodelle.

Eine Geschäftsadresse in Berlin kann dabei nicht nur formale Vorteile bieten, sondern auch die Außenwirkung eines Unternehmens stärken.

Gleichzeitig ist die Expansion bereits geplant:

- München als nächster zentraler Standort

- perspektivische Erweiterung nach Hamburg und Frankfurt

Diese Entwicklung zeigt, dass das Modell skalierbar ist und sich an unterschiedliche Märkte anpassen lässt.

Digitale Prozesse als Fundament

Ein zentraler Bestandteil des Konzepts ist die konsequente Digitalisierung administrativer Abläufe. Prozesse, die traditionell zeitintensiv und papierbasiert sind, werden hier strukturiert und vereinfacht.

Dazu gehören unter anderem:

- digitale Erfassung und Archivierung von Dokumenten

- ortsunabhängiger Zugriff auf Post und Unterlagen

- klare Strukturierung von Geschäftsprozessen

Der Vorteil liegt in der Transparenz: Unternehmen behalten jederzeit den Überblick über ihre Dokumente und können schnell auf relevante Informationen zugreifen.

Flexible Nutzung von Meetingräumen

Neben den digitalen Services bietet MANA die Möglichkeit, Meetingräume bei Bedarf zu nutzen. Diese können flexibel gebucht werden und eignen sich für unterschiedliche Einsatzbereiche:

- Kundentermine

- Präsentationen

- interne Besprechungen

Dadurch entsteht eine Kombination aus digitaler Flexibilität und physischer Infrastruktur – ohne langfristige Verpflichtungen für feste Büroflächen.

Für wen das Modell besonders geeignet ist

Das Angebot von MANA richtet sich vor allem an Unternehmen, die flexibel arbeiten und gleichzeitig professionelle Strukturen benötigen.

Dazu zählen insbesondere:

- Start-ups in der Aufbauphase

- Selbstständige und Freelancer

- kleine und mittlere Unternehmen

Besonders relevant ist das Modell für Unternehmen, die keine eigenen Büroräume benötigen oder bewusst auf flexible Lösungen setzen. Gleichzeitig profitieren alle, die administrative Prozesse auslagern möchten, ohne die Kontrolle zu verlieren.

Einordnung im Wettbewerbsumfeld

Der Markt für Virtual Offices wächst seit Jahren kontinuierlich und wird zunehmend vielfältiger. Zahlreiche Anbieter positionieren sich mit ähnlichen Grundangeboten, unterscheiden sich jedoch deutlich in ihrer Umsetzung, ihrem Serviceverständnis und ihrer Zielgruppenansprache. Während viele Lösungen stark standardisiert und auf Skalierung ausgelegt sind, zeigt sich bei genauerem Hinsehen, dass nicht alle Anbieter denselben Anspruch an Betreuung und Struktur verfolgen.

MANA wählt hier bewusst einen differenzierten Ansatz. Im Fokus stehen nicht allein digitale Prozesse, sondern deren Kombination mit persönlicher Betreuung und klar nachvollziehbaren Abläufen. Statt anonymer Massenabwicklung setzt das Unternehmen auf direkte Ansprechpartner und eine Zusammenarbeit, die stärker auf individuelle Anforderungen eingeht.

Das zeigt sich insbesondere in:

- dem Fokus auf persönliche Betreuung statt standardisierter Prozesse

- der Verbindung aus digitaler Infrastruktur und individueller Unterstützung

- klar strukturierten, verständlichen Abläufen ohne unnötige Komplexität

Diese Ausrichtung spricht vor allem Unternehmen an, die neben Effizienz auch Wert auf Verlässlichkeit, Transparenz und direkte Kommunikation legen. Gerade für kleinere Unternehmen und Gründer kann dieser Ansatz einen spürbaren Unterschied im Alltag machen.

In einem Interview von MANA mit business-on wird zudem deutlich, wie stark der Fokus auf praxisnahe Lösungen und persönliche Zusammenarbeit gelegt wird – insbesondere mit Blick auf die Bedürfnisse kleiner und wachsender Unternehmen.

Skalierbarkeit und Zukunftsperspektiven

Das Konzept von MANA ist darauf ausgelegt, mit den Anforderungen moderner Unternehmen mitzuwachsen. Gerade in einem Umfeld, das zunehmend von Digitalisierung, Flexibilität und dynamischen Geschäftsmodellen geprägt ist, gewinnen skalierbare Lösungen an Bedeutung. Unternehmen benötigen Strukturen, die sich anpassen lassen – sowohl in frühen Gründungsphasen als auch im weiteren Wachstum.

Digitalisierung, Automatisierung und ortsunabhängige Arbeitsmodelle werden dabei weiterhin eine zentrale Rolle spielen. Lösungen wie die von MANA greifen genau diese Entwicklung auf, indem sie administrative Prozesse vereinfachen und gleichzeitig flexibel erweiterbar bleiben.

Mögliche Entwicklungen umfassen:

- den weiteren Ausbau digitaler Services und automatisierter Abläufe

- die Erweiterung auf zusätzliche Städte und wirtschaftlich relevante Standorte

- die kontinuierliche Optimierung der Nutzererfahrung und Prozessstruktur

Gleichzeitig bleibt der persönliche Ansatz ein wesentlicher Bestandteil des Modells. Auch im Zuge des Wachstums steht die direkte Betreuung im Vordergrund – ein Aspekt, der insbesondere für kleinere Unternehmen und Gründer eine wichtige Rolle spielt. Die Herausforderung wird darin liegen, Skalierung und persönliche Betreuung langfristig in Einklang zu halten.

Fazit

MANA steht exemplarisch für eine Entwicklung, die viele Unternehmen aktuell betrifft: Administrative Prozesse werden zunehmend ausgelagert und digitalisiert, um Ressourcen zu sparen und Abläufe effizienter zu gestalten. Virtual Office Services entwickeln sich dabei von einer ergänzenden Lösung hin zu einem eigenständigen Organisationsmodell, das sich flexibel in unterschiedliche Unternehmensstrukturen integrieren lässt.

Die Kombination aus ladungsfähiger Geschäftsadresse, digitalem Postservice und persönlicher Betreuung bietet eine klar strukturierte Grundlage für den Unternehmensalltag. Besonders für Start-ups, Selbstständige und kleinere Unternehmen entsteht dadurch ein Umfeld, das sowohl Flexibilität als auch Verlässlichkeit ermöglicht – ohne die Notwendigkeit, eigene komplexe Infrastrukturen aufzubauen.

Mit Blick auf die weitere Entwicklung digitaler Arbeitsmodelle ist davon auszugehen, dass die Nachfrage nach solchen Lösungen weiter steigen wird. Unternehmen, die frühzeitig auf strukturierte, digitale und gleichzeitig persönliche Systeme setzen, schaffen sich damit eine stabile Basis für nachhaltiges Wachstum und langfristige Anpassungsfähigkeit.

ODONATAs Sprung zur Multi-Mission-Drohne

Vom scheiternden Lufttaxi-Traum zum taktischen Technologieträger: Das Münchner Start-up ODONATA hat mit dem PANTALA-Hovertest einen entscheidenden Pivot eingeleitet. Am 10. April 2026 erreichte das Unternehmen auf dem Militärflughafen der Bundeswehr im fränkischen Roth einen Meilenstein und absolvierte den ersten Schwebeflug des 1:1-Prototyps seiner Langstreckendrohne. Doch hinter der Erfolgsmeldung steckt eine tiefgreifende strategische Neuausrichtung des 2021 von Dennis Furchheim, Tobias Nickel und Dominik Weigl gegründeten Unternehmens. Wir haben uns mit Co-Founder Dennis Furchheim darüber ausgetauscht.

Gegründet im Jahr 2021 im Rahmen des ESA-Business-Incubation-Programms, verfolgten die ODONATA-Gründer Dennis Furchheim, Tobias Nickel und Dominik Weigl ursprünglich eine weitaus kapitalintensivere Vision: ein bemanntes, wasserstoffbasiertes Flugtaxi (eVTOL). Doch die Realität der Finanzmärkte zwang das Team zum Umdenken. „Die Finanzierung eines solchen Vorhabens ist grundsätzlich schon nicht einfach“, erinnert sich CEO Dennis Furchheim an die kritischen Phasen der letzten fünf Jahre.

Besonders die Probleme anderer Branchengrößen belasteten das junge Unternehmen: „Wenn aber die Entwicklungen, wie beispielsweise bei Lilium, einen in Sippenhaft nehmen, weil nicht unterschieden wird zwischen verschiedenen Konzepten, dann wird es noch härter.“ In dieser Situation habe der „Zeitenwechsel“ und der neue Fokus auf Dual-Use den nötigen Befreiungsschlag ermöglicht.

Mitte 2024 folgte der scharfe Kurswechsel weg vom zertifizierungsrechtlich komplexen Passagiermarkt. Furchheim räumt offen ein, dass dies auch eine Reaktion auf den Standort Deutschland war: „Wir haben ursprünglich mit dem Ziel gestartet, ein eVTOL für Passagiere zu entwickeln und zu produzieren. Wir haben allerdings lernen müssen, dass Investoren in Deutschland nicht in so langfristig angelegte Projekte investieren.“

Der Schwenk zur autonomen Drohne PANTALA sei zwar „hart“ gewesen, doch das Team konnte wertvolle Erfahrungen und Technologien aus der ersten Phase transferieren.

PANTALA: Technik mit Schwerpunkt-Trick

Die nun getestete PANTALA-Drohne ist als Multi-Mission-Plattform konzipiert, die Logistik, Lagebildgewinnung und Drohnenabwehr vereint. Mit einer Spannweite von 7,9 Metern und einem maximalen Startgewicht von 280 Kilogramm kann sie bis zu 80 Kilogramm Nutzlast transportieren. Dank einer hybriden Antriebsarchitektur – batterieelektrisch für Start und Landung, ein Kraftstoffsystem für den Reiseflug – soll sie über zehn Stunden in der Luft bleiben und eine Reichweite von mehr als 1.100 Kilometern erzielen.

Ein technologisches Highlight ist der zum Patent angemeldete verschiebbare Antriebsstrang, der die Schwerpunktsanpassung im Flug bei variierenden Lasten ermöglicht. Angesprochen auf die Zukunftsfähigkeit des Antriebs gibt sich der Gründer pragmatisch. „Wir haben uns bewusst technologieoffen aufgestellt“, betont Furchheim im Hinblick auf die noch fehlende Wasserstoff-Infrastruktur. Er verspricht: „So können wir mit klassischen Treibstoffen, elektrisch und künftig auch mit Wasserstoff fliegen, je nachdem, wie die Infrastruktur sich entwickelt.“

Der Marktdruck und die Konkurrenz

Obwohl ODONATA durch Partner wie die ESA und die TUM Venture Labs Aerospace unterstützt wird, bleibt der Kapitalbedarf massiv. Im Wettbewerb mit bereits etablierten Playern wie Quantum Systems muss sich das Start-up behaupten. Furchheim sieht sein Unternehmen jedoch technologisch im Vorteil.

„Wir haben zwei zentrale Vorteile“, erklärt der CEO selbstbewusst: „Zum einen haben wir eine höhere Payload mit bis zu achtzig Kilogramm, was uns ermöglicht, ganz neue Use-Cases zu bedienen.“ Zudem ermögliche die enorme Reichweite eine Überwachung von Frontabschnitten oder kritischer Infrastruktur über viele Stunden hinweg. Laut Furchheim gibt es bereits konkrete Gespräche mit Interessenten, „die genau auf so etwas warten“.

Zwischen Ethik und Skalierung

Die Ausrichtung auf den Sicherheitssektor bringt neben internationalem Interesse aus den USA, Indien oder der Ukraine auch strikte Rüstungsexportkontrollen mit sich. Auf die Frage nach den regulatorischen Hürden beim Export von Dual-Use-Gütern reagiert der Gründer zurückhaltend, deutet aber eine enge Abstimmung mit nationalen Stellen an. „Ohne zu viel zu verraten, wir sind im Gespräch mit der Bundeswehr, damit wir unser System auf diese Anforderungen hin optimieren“, erklärt Furchheim, räumt jedoch ein: „Aber es ist natürlich eine Hürde, die es nicht leichter macht.“

Der erfolgreiche Hovering-Test markiert den bisher wichtigsten Fortschritt. Der nächste entscheidende Lackmustest für ODONATA wird nun der aerodynamisch anspruchsvolle Übergang in den Reiseflug sein. Nur wenn dieser nahtlos gelingt, wird das System die wachsende internationale Nachfrage tatsächlich bedienen können.

Diingu: Kampf gegen den Fachkräftemangel im Sozialwesen

Das Diingu-Gründerteam aus Frankfurt will den eklatanten Fachkräftemangel im Sozialwesen mit einer digitalen Lern- und Jobplattform bekämpfen. Das Start-up hat namhafte Träger*innen an Bord und spricht nun mit internationalen Investor*innen. Doch wie tragfähig ist das Geschäftsmodell in einem chronisch unterfinanzierten Markt, und wie realistisch sind die europäischen Skalierungsträume? Wir haben nachgefragt.

Wer sich den Pitch von Sahm Shojai, Geschäftsführer der Frankfurter Diingu GmbH, durchliest, spürt schnell den typischen Start-up-Idealismus. Es geht um „konkrete Wirkung“, „soziale Teilhabe“ und die Vision einer „globalen sozialen Infrastruktur“, um weltweit die Lebensrealität von Kindern zu verbessern. Das klingt zweifellos gut im Pitch-Deck für potente VCs. Doch zieht man die schillernde Marketing-Ebene ab, bleibt ein konkretes und weitaus pragmatischeres Kerngeschäft. Diingu ist im Kern eine E-Learning- und Recruiting-Plattform für pädagogische Assistenzkräfte. Es handelt sich um ein klassisches B2B2C-Modell in einer Nische, die von der Digitalisierung bislang stiefmütterlich behandelt wurde.

Vom Bruder-„Frust“ zum Uni-Spin-off

Die Geschichte von Diingu – kurz für Digital Inclusion Guide – beginnt im echten Leben. Der Bruder von Mitgründer Sahm Shojai arbeitete als Schulbegleiter und berichtete von den massiven Herausforderungen in seinem Job. Das grundlegende Problem: Immer mehr ungelernte Quereinsteiger*innen strömen in die soziale Branche, denen es eklatant an fachlicher Einarbeitung, Fortbildungen und Qualitätsstandards mangelt.

Aus diesem Engpass formten Sahm Shojai und seine Mitgründer Felix Kolb und Florian Kranz eine digitale Lösung. Dabei gingen sie methodisch klug vor und holten sich von Beginn an wissenschaftliche Expertise ins Boot. Unter der Mentorenschaft von Prof. Dr. Wolfgang Dworschak vom Lehrstuhl für Pädagogik bei geistiger Behinderung an der Universität Regensburg wurde das Start-up als Ausgründung der Hochschule etabliert. Das sicherte dem Team nicht nur ein exist-Gründerstipendium, sondern 2023 auch den Hochschulgründerpreis sowie den 2. Platz beim Frankfurter Gründerpreis. Die Plattform profitiert stark von diesem Fundament, denn die Inhalte sind keine bloßen Wikipedia-Zusammenfassungen, sondern wissenschaftlich fundierte, praxisnahe Kurse.

Doch wie stellt das Team sicher, dass das akademische Wissen der Uni Regensburg nicht zu theoretisch ist und an der rauen Realität einer überforderten Hilfskraft in einer Brennpunkt-Schule vorbeigeht? „Die Entwicklung der Kursinhalte findet mit sorgfältig ausgewählten Experten und Expertinnen statt“, versichert Shojai. Diese verfügten nicht nur über den nötigen akademischen Bezug, sondern brächten auch umfassende praktische Erfahrung mit. „Wir geben klare Richtlinien für die sprachliche Ausgestaltung der Kurse vor und legen großen Wert darauf, dass der Fokus auf praxisnahen Inhalten liegt“, betont der Gründer.

Um die Theorie-Praxis-Lücke zu schließen, fließen daher neben Fachliteratur vor allem persönliche Praxiserfahrungen in die Entwicklung ein. Zudem belässt es Diingu nicht bei der Uni Regensburg, die primär mit Forschungsarbeiten die Qualität sichert. Man kooperiert laut Shojai ebenfalls mit der LMU München, wo der Schwerpunkt auf formativer Diagnostik und Monitoring-Services liege. „Gemeinsam entwickeln wir beispielsweise aktuell ein KI-Tool, das Verhalten- und Risikoanalysen bei Kindern und Jugendlichen durchführen kann“, kündigt der Geschäftsführer an. Sozialarbeitende sollen dadurch befähigt werden, Kindeswohlgefährdungen besser zu erkennen. „Diese innovativen Services sollen den Arbeitsalltag professionalisieren“, resümiert er.

E-Learning trifft auf Jobbörse

Diingu fungiert als zweiseitiger Marktplatz. Auf der einen Seite stehen Privatpersonen wie Schulbegleitende, Kita-Kräfte oder Familienhelfer*innen. Sie können sich gegen eine monatliche Gebühr von aktuell 15 Euro flexibel über mehr als 70 Online-Kurse zu Themen wie Autismus oder ADHS weiterbilden. Bei Verständnisfragen hilft ein KI-Chatbot. Mit den erworbenen Zertifikaten bauen sich die Nutzer*innen dann ein digitales Profil auf. Auf der anderen Seite stehen die großen Träger wie das DRK, die Johanniter oder die Lebenshilfe. Sie zahlen für jährliche Lizenzen, um ihr bestehendes Personal digital zu schulen, Nachweise zentral zu verwalten und schlichtweg Verwaltungskosten zu sparen.

Hand aufs Herz: Wie viele der ohnehin meist schlecht bezahlten pädagogischen Hilfskräfte zahlen die 15 Euro im Monat wirklich selbst aus eigener Tasche? Und plant Diingu langfristig nicht doch einen kompletten Pivot zum lukrativeren, reinen B2B-Modell? Shojai holt bei dieser Frage etwas weiter aus: Man sei vor rund drei Jahren ursprünglich als reine Lernplattform im B2B-Bereich gestartet. Träger nutzten die Kurse zur Schulung des eigenen Personals. „Mit der Zeit erhielten wir jedoch auch zunehmend Anfragen von Privatpersonen, die sich mit unseren Inhalten weiterbilden möchten, um sich auf einen Job im sozialen Bereich zu bewerben“, blickt er zurück. Daraufhin habe man dasselbe Lernangebot über eine App auch für B2C-Kund*innen geöffnet, um die berufliche Vorqualifizierung zu ermöglichen. Gleichzeitig wurde die Jobplattform gelauncht, um beide Kund*innengruppen zusammenzubringen.

Auf die Skepsis bezüglich der privaten Zahlungsbereitschaft kontert Shojai selbstbewusst: „Das sind Menschen, die einen Job im sozialen Bereich suchen und davon gibt es viele, weil der Fachkräftemangel eine sehr hohe Nachfrage nach beruflicher Weiterbildung erzeugt.“ Er spricht im gleichen Atemzug gar von einer handfesten Marktdisruption. Klassische Fortbildungen zur Schulbegleitung kosteten bei anderen Bildungsträgern schnell zwischen 800 und 1.200 Euro. Dies werde heute meist über Bildungsgutscheine finanziert.

Doch genau hier wittert Diingu seine strategische Chance: „Diese Finanzierung über Bildungsgutscheine wird sich mit der Grundsicherung ab Juli 2026 ebenfalls verändern“, prognostiziert Shojai. Aufgrund des Vermittlungsvorrangs würden die Gutscheine künftig nicht mehr so großzügig vergeben. Diingu hingegen biete Wissen für zahlreiche Berufe bereits ab 15 Euro an. „Mit anderen Worten: Wir haben diesen Markt demokratisiert und Wissen überhaupt erst auf Selbstzahlerbasis bezahlbar gemacht“, stellt er klar. Selbst ohne große Werbung könne man erste bezahlte Abonnements vorweisen. „In den kommenden Monaten planen wir, größere Kampagnen zu launchen und mittelfristig den B2B2C-Weiterbildungsmarkt für soziale Berufe mit unserem Selbstzahler-Konzept und unserem E-Learning-Ansatz zu übernehmen“, gibt sich der Geschäftsführer kämpferisch.

Der eigentliche Clou – und das potenzielle Schwungrad des Geschäftsmodells – ist jedoch die Verzahnung: Träger können über das Diingu-Jobportal direkt auf die vorqualifizierten Privatnutzer zugreifen und diese rekrutieren. Doch die großen Wohlfahrtsverbände gelten oft als extrem schwerfällig in der Digitalisierung. Wie hart war es, Traditionsverbände wie das DRK davon zu überzeugen, ihr Recruiting über ein noch unbekanntes Start-up abzuwickeln? Shojai räumt ein, dass die Anfangszeit kein Selbstläufer war. „Digitalisierung bedeutete für viele im sozialen Bereich vor allem Veränderung“, analysiert er. „Und Veränderungen vermeidet man gern, solange nichts anbrennt.“ Heute punkte man schlichtweg mit einem guten Service zum erschwinglichen Preis, weshalb immer mehr große Träger Diingu ausprobieren wollten. Die Einführung bei den Platzhirschen erfordere natürlich Prozessumstellungen, was aber branchenübergreifend bei Großunternehmen der Fall sei. Dennoch gibt der Gründer zu: „Aber ja, keine Frage: Sales war bisher die größte Herausforderung in diesem Unternehmen.“ Das Geschäftsmodell und die Verkaufsstrategien mussten mehrfach nachgeschärft werden. Heute, so Shojai, sei es aber „deutlich einfacher geworden als noch zu Beginn“.

Markt & Wettbewerb

Der Markt für soziale Dienstleistungen ist riesig, aber extrem komplex. Der Fachkräftemangel ist immens; Träger müssen notgedrungen auf ungelernte Hilfskräfte zurückgreifen, was unweigerlich die Qualität der Betreuung gefährdet. Hier trifft Diingu einen echten Pain Point. Der Wettbewerb besteht derzeit vor allem aus den analogen Akademien der Wohlfahrtsverbände, regionalen Fortbildungsanbietern und stark generalisierten E-Learning-Plattformen. Auch klassische Recruiting-Plattformen mischen mit. Diingu grenzt sich durch die spitze Zielgruppe rund um Inklusion und Schulbegleitung sowie durch die intelligente Kombination aus Qualifizierung und Recruiting ab.

Skalierungsträume vs. Marktrealität

So lobenswert der Ansatz ist, das Geschäftsmodell muss sich im Härtetest einigen kritischen Fragen stellen. Ein massives Problem ist der Markt als regulatorischer Flickenteppich. Diingu spricht aktuell mit Investor*innen, um europaweit zu skalieren, doch das Sozial- und Bildungswesen ist hochgradig lokalisiert. Da sich die Vorgaben für Inklusion in Deutschland bereits von Bundesland zu Bundesland massiv unterscheiden, bedeutet eine europäische Expansion zwingend, dass Fortbildungsinhalte an völlig andere gesetzliche Rahmenbedingungen angepasst werden müssen. Das kostet enorm viel Zeit und verbrennt Kapital.

Wie will Diingu diese gewaltige regulatorische Wand durchbrechen, ohne sich finanziell und personell zu verheben? „Das ist eigentlich die entscheidendste Frage, und genau diese begleitet uns seit fast zwei Jahren“, gibt Shojai offen zu. Mit der Lösung stehe und falle der internationale Erfolg. Die Antwort des Start-ups lautet: Automatisierung. Man entwickle gerade eine zweigeteilte „Kursfabrik“. Eine Abteilung konzipiere kleinere Kurse mithilfe von Künstlicher Intelligenz, die am Ende lediglich von Expert*innen lektoriert und qualitätsgeprüft werden. Dafür habe man eigens eine von AWS geförderte Kooperation zur Entwicklung generativer KI-Anwendungen gestartet, um einen skalierbaren Workflow zu etablieren.

Große und wichtige Kurse bleiben jedoch Handarbeit nach strengen Richtlinien. „KI kommt da nicht hin, und ihr fehlt auch reales Praxiswissen, das nur ausgewählte Expertinnen und Experten mitbringen“, stellt Shojai klar. Diese Zweiteilung bedingt logischerweise extrem hohe Kosten bei der Lokalisierung der Inhalte. Auf die konkrete Frage nach der Finanzierbarkeit bleibt der Gründer allerdings unkonkret. Man habe zwar bereits eine „finanzstrategische Lösung“ erarbeitet, doch Details wolle er zum jetzigen Zeitpunkt noch nicht verraten. Er gibt sich jedoch siegessicher: „Wir glauben, mit diesem hybriden KI-Mensch-Kursentwicklungsansatz einen entscheidenden Wettbewerbsvorteil zu erlangen.“

Gleichzeitig stößt das Modell unweigerlich an die Grenzen der Digitalisierung. Das Start-up wirbt mit einem KI-Guide, in der sozialen Arbeit gilt jedoch unumstößlich das Credo: Beziehung vor Technik. Empathie, Deeskalation und der Umgang mit schwer beeinträchtigten Kindern lassen sich über Klick-Kurse und KI-Chats nur in der grauen Theorie erlernen. Eine reine Digitalisierung der Fortbildung ersetzt keine Praxisbegleitung im wahren Leben.

Abschließend wirft auch das avisierte „Big Picture“ rund um die Vision „Diingu Care“ Fragen auf. Die Ankündigung, künftig weltweit Bildungsprojekte zu unterstützen, wirkt aktuell noch wie ein sehr ambitioniertes PR-Versprechen für Impact-Investor*innen. Für ein Start-up in der vulnerablen Skalierungsphase birgt ein solcher Nebenschauplatz stets die Gefahr, den Fokus auf das stark erklärungsbedürftige DACH-Kerngeschäft zu verlieren.

Lenkt diese noble globale Vision das Team nicht gefährlich vom eigentlichen Überlebenskampf und der schwierigen Marktdurchdringung in Europa ab? „Absolut“, stimmt Shojai überraschend direkt zu. Genau aus diesem Grund bewerbe man das Projekt derzeit weder öffentlich noch bei Investor*innen. „Es steht weder auf der Website noch auf irgendeinem Pitch Deck“, versichert er. Der Fokus liege aktuell ausschließlich auf dem Aufbau eines funktionierenden und stark wachsenden Geschäfts. „Erst wenn wir damit Investoren und auch uns selbst geholfen haben, können wir anfangen, mit Diingu Care anderen zu helfen“, erklärt Shojai sein strategisches Prinzip. Dennoch ist es ihm spürbar ein Anliegen zu betonen, dass Diingu Care keine hohle PR-Phrase sei. Diese globale Infrastruktur für Länder ohne stabile soziale Systeme werde unweigerlich kommen. „Und an diesem Ziel wird sich auch nichts ändern, nur weil es ambitioniert ist“, bekräftigt der Geschäftsführer abschließend. „Denn genau das soll Diingu ausmachen: eine Organisation, die Verantwortung übernimmt.“

Fazit

Diingu ist ein exzellentes Beispiel dafür, wie aus einem echten, greifbaren Alltagsproblem eine kluge SaaS-Lösung entstehen kann. Das Team hat durch die universitäre Anbindung seine Hausaufgaben gemacht und mit über 100 Trägern bereits beachtliche Traction im B2B-Markt erreicht. Der Weg zum europaweiten Skalierungserfolg oder gar zur „globalen sozialen Infrastruktur“ wird jedoch steinig. VCs werden künftig genau prüfen, ob die Margen im chronisch klammen Sozialsektor ausreichen und ob der stark regulierte Bildungsmarkt schnelle geografische Sprünge überhaupt zulässt. Diingu muss jetzt beweisen, dass es nicht nur ein nützliches Werkzeug für deutsche Wohlfahrtsverbände bietet, sondern das Zeug zu einem hochprofitablen, grenzüberschreitenden Plattformgeschäft hat.

Start-up-Report: Creator Support Services

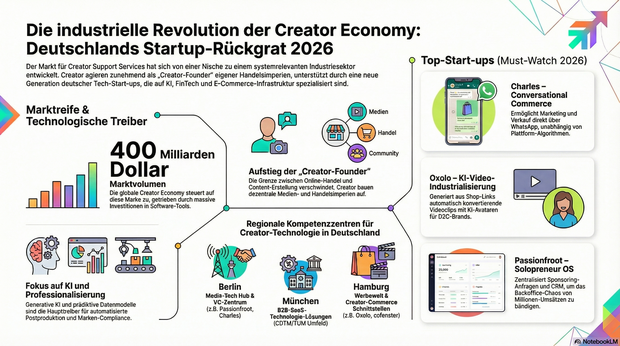

Die industrielle Revolution der Creator*innen ist in vollem Gange: Unser Report beleuchtet den boomenden Markt und zeigt die deutschen Tech-Start-ups, die das Rückgrat der neuen Medien-Champions bauen.

Wir erleben das Entstehen einer neuen ökonomischen Spezies: Der Creator-Founder. Die Grenze zwischen dem/der klassischen Online-Händler*in und dem/der modernen Content-Creator*in ist endgültig gefallen. Wer heute Reichweite besitzt, baut keine Community mehr auf, sondern ein dezentrales Medien- und Handelsimperium. Diese Transformation vom Nischenthema zur Systemrelevanz braucht jedoch eine industrielle Basis. Genau hier betritt eine neue Generation von Start-ups die Bühne. Diese „Werkzeugmacher*innen“ – spezialisiert auf KI-gesteuerte Produktion, autonome Analyse und FinTech – bilden das unsichtbare, hochprofitable Rückgrat einer Branche, die gerade ihre industrielle Revolution erlebt.

Das Ökosystem wird erwachsen

Die Marktlage im Jahr 2026 beweist eindrucksvoll, dass die Werkzeug-Infrastruktur für digitale Entrepreneur*innen den Kinderschuhen entwachsen ist. Laut aktuellen Hochrechnungen etablierter Investmentbanken steuert die globale Creator Economy unaufhaltsam auf die 400-Milliarden-Dollar-Marke zu, wobei ein signifikanter zweistelliger Prozentsatz direkt in Software- und Servicetools fließt.

Auch in Deutschland bestätigt der jüngste KfW-Gründungsmonitor diese Reife: Software-Lösungen für digitale Medienschaffende gehören zu den widerstandsfähigsten B2B-Segmenten der Post-Krisen-Ära. Der technologische Haupttreiber dieser rasanten Professionalisierung ist zweifellos die angewandte generative künstliche Intelligenz, dicht gefolgt von prädiktiven Datenmodellen. Deutsche Risikokapitalgeber*innen haben im vergangenen Jahr schätzungsweise über 350 Millionen Euro spezifisch in dieses Vertical gepumpt. Es geht längst nicht mehr um experimentelles Wagniskapital, sondern um Growth-Metriken und wiederkehrende SaaS-Umsätze in einem Markt, der eine beispiellose Professionalisierung erfährt.

Technologien der totalen Integration

Blickt man jenseits der offensichtlichen Dashboards, offenbaren sich die wahren Maschinenräume dieses Jahres. Drei Sub-Sektoren dominieren aktuell das Geschehen und treiben die Verschmelzung von Commerce und Content voran. Zunächst ist da die autonome KI-Postproduktion, bei der Algorithmen nicht nur schneiden, sondern selbständig Narrative für Verkaufsformate generieren.

Ein weiterer massiver Treiber ist die prädiktive Marken-Compliance. Hierbei handelt es sich um Legal-Tech-Lösungen, die vollautomatisiert Werbekennzeichnungspflichten und internationale Steuermodelle für Creator-Marken überwachen.

Schließlich etabliert sich das Creator FinTech, insbesondere durch umsatzbasierte Finanzierungsmodelle, die den dynamischen Cashflow von Influencer-Brands algorithmisch bewerten können. Während Pioniere der ersten Welle wie Linktree lediglich Brücken bauten, stoßen die aktuellen Akteure tief in diese hochkomplexen, technologischen Nischen vor, um den Creator*innen als vollwertigen E-Commerce-Akteur*innen zu befähigen.

Reality Check: Der Kater nach dem Hype

Dass diese Branche jedoch kein automatischer Garant für Einhörner ist, bewies der spektakuläre Crash der Web3-Creator-Plattformen um das Jahr 2023. Hochgelobte Projekte wie BitClout verbrannten Hunderte Millionen Dollar an Risikokapital, weil sie die Usability vernachlässigten und keinen echten Nutzwert jenseits der Spekulation boten. Aus diesem schmerzhaften Reality Check lassen sich vier fatale Fallstricke für heutige Gründer*innen ableiten. Der erste Fehler ist das API-Klumpenrisiko, also die blinde Abhängigkeit von den Launen großer Plattformen wie Meta oder YouTube. Ein zweites, oft tödliches Problem sind katastrophale Unit Economics bei Tools, die nur den nicht-monetarisierbaren "Long Tail" der Hobby-Nutzer*innen bedienen. Der dritte Fallstrick ist die chronische Unterschätzung der Regulatorik, insbesondere des EU AI Acts. Das vierte Learning betrifft den Technologie-Fetischismus: Wer Lösungen aufzwingt, die technologisch brillieren, aber in der alltäglichen User Experience der Creator*innen versagen, wird vom Markt gnadenlos abgestraft.

Deutschlands heimliche Creator-Hubs

Die architektonische Landkarte der deutschen Creator-Tool-Landschaft konzentriert sich 2026 auf hochspezialisierte Hotspots. Berlin bleibt der unangefochtene Magnet, angetrieben von einer dichten Konzentration an Media-Tech-VCs und der Strahlkraft von Kaderschmieden wie der ESMT. München agiert als das kraftvolle Gegenstück für harte Technologiebedingungen. Angefacht durch das CDTM und die TU München, entstehen hier vor allem datenlastige B2B-SaaS-Produkte für die Industrie. Das Rheinland, spezifisch die Achse Aachen und Köln, fungiert als historisch gewachsenes Cluster, das auf dem Fundament klassischer TV-Produktionen und starken Informatik-Fakultäten wie der RWTH Aachen basiert. Abgerundet wird dieses Netzwerk durch Hamburg. Die Hansestadt nutzt ihre tiefe Verwurzelung in der Werbe- und Agenturwelt sowie Netzwerke wie den Next Media Accelerator, um Tools zu entwickeln, die genau an der Schnittstelle zwischen Markenbudgets und der Creator-Commerce-Welt ansetzen.

Investor*innen-Radar

Ein genauer Blick auf die Geldgeber*innen offenbart, wer das Benzin für diese Maschine liefert. Bei den spezialisierten VCs haben Akteure wie Creator Ventures den Takt vorgegeben, während in Deutschland vor allem Vehikel rund um OMR Ventures den tiefen Brancheneinblick für Seed-Finanzierungen nutzen. Auf der Ebene der Top-Tier Generalisten sehen wir Fonds wie Creandum, Cherry Ventures und Point Nine, die ihre rigorosen B2B-SaaS-Metriken nun konsequent auf Creator-Tools anwenden. Die Industrie mischt über Corporate VCs ebenfalls kräftig mit; hier sichern sich Bertelsmann Investments oder SevenVentures strategische Marktanteile, um ihre eigenen Wertschöpfungsketten zu digitalisieren. Der eigentliche Motor der Frühphase sind jedoch die Business Angels und Syndikate. Hier agieren Digitalgrößen wie Philipp Westermeyer oder Prominente wie Mario Götze als strategische Türöffner, die den Start-ups unmittelbaren Zugang zu jener Creator-Elite verschaffen, die heute die Märkte bewegt.

Die Top Start-ups (Must-Watch 2026)

Die für diesen Report ausgewählten Start-ups wurden anhand einer rigorosen Analyse ihrer Marktrelevanz im Jahr 2026, ihres technologischen Reifegrades sowie der Stabilität ihrer Geschäftsmodelle bewertet. Ein wesentliches Kriterium war zudem das Investoren-Vertrauen durch namhafte Risikokapitalgeber. Wir betrachten ausschließlich Unternehmen mit Hauptsitz in Deutschland, die ab dem Jahr 2020 gegründet wurden, um den aktuellen Innovationszyklus der "Post-Plattform-Ära" präzise abzubilden – jene Ära, in der Creator zu echten Handelsmarken werden.

Passionfroot (Gegründet 2021)

Das Team um Jennifer Phan, Jens Willemen und Michelle Tian hat von Berlin aus einen globalen Standard gesetzt. Ihr B2B-SaaS-Modell bietet einen ganzheitlichen Workspace, der Sponsoring-Anfragen und CRM für Creator zentralisiert. Der USP ist die radikale Vereinfachung des Backoffice-Chaos für jene „Solopreneur*innen“, die heute Millionenumsätze verwalten. Namhafte VCs wie Creandum und Cherry Ventures investierten hier in einer Seed-Runde 3 Millionen Euro in Passionfroot.

Nindo (Gegründet 2020)

Gegründet von Rezo und Tim Jacken in Aachen, ist Nindo der Inbegriff für den Sprung von Content-Expertise zu tiefen B2B-Data-SaaS-Lösungen. Das Unternehmen bietet granularste Analytics und Reichweiten-Validierungen für das Influencer-Marketing. Durch den Einstieg und die strategische Partnerschaft mit dem globalen Medienhaus Webedia stützt Nindo heute maßgeblich das Wachstum jener Marken, die auf datenbasierte und verifizierte Creator-Kooperationen setzen.

cofenster (Gegründet 2020)

Die Hamburger Gründer Tom Vollmer, Oliver Wegner und Finn Frotscher adressieren die „Corporate Creator Economy“. Ihr Tool ermöglicht es Unternehmen, Mitarbeiter-Content via KI-Guidance in professionelle Verkaufs- und Info-Videos zu verwandeln. Dieser Ansatz sicherte cofenster unter anderem eine Seed-Finanzierung in Höhe von 1,5 Millionen Euro, angeführt von Capnamic Ventures.

Charles (Gegründet 2020)

Artjem Weissbeck und Andreas Tussing bringen mit Charles Conversational Commerce nach Berlin. Ihr SaaS-Modell erlaubt es E-Commerce- und Creator-Brands, Marketing und Verkauf vollständig über WhatsApp abzuwickeln. Der USP liegt in der direkten Monetarisierung ohne Algorithmus-Abhängigkeit, was Salesforce Ventures im Rahmen einer Series-A-Runde zu einem Investment von 20 Millionen Dollar veranlasste.

Wonnda (Gegründet 2022)

Das Berliner Duo Martin Ditzel und Oliver Allmoslechner schließt die Lücke zwischen digitaler Reichweite und physischem Handel. Als B2B-Marktplatz verbindet Wonnda Creator*innen mit europäischen Hersteller*innen für Eigenmarken. Die Plattform digitalisiert das Sourcing und zementiert den Trend zum „Creator-as-a-Manufacturer“, finanziert von namhaften Frühphasen-VCs wie Pitchdrive.

Oxolo (Gegründet 2020)

Das Hamburger Team um Elisabeth L’Orange und Heiko Hubertz besetzt die entscheidende Schnittstelle, an der 2026 die Grenze zwischen klassischem E-Commerce und Creator-Content endgültig verschwindet. Ihr „URL-to-Video“-Modell generiert aus schlichten Shop-Links hochgradig konvertierende Videoclips mit KI-Avataren. Dass Oxolo primär von „Sellern“ spricht, ist ein strategisches Understatement: In Wahrheit nutzen vor allem Creator-Founders das Tool, um ihre D2C-Brands zu industrialisieren. Mit einer Series-A-Finanzierung von 13 Millionen Euro (Lead: DN Capital) ist Oxolo der unsichtbare Motor hinter dem kommerziellen Erfolg moderner Creator-Marken.

Moojo (Gegründet 2021)

Das Berliner Start-up von Amir Djouadi, Christian Engnath und Utena Treves fungiert als das finanzielle Rückgrat der dezentralen Wirtschaft. Moojo bietet eine integrierte FinTech-Lösung, die Rechnungsstellung und sofortige Auszahlungen für Creator*innen automatisiert. Durch die Reduzierung von Zahlungsverzögerungen löst das Start-up eines der größten Liquiditätsprobleme der Branche, unterstützt durch ein 2-Millionen-Dollar-Pre-Seed-Funding von b2venture und APX.

ZebraCat (Gegründet 2022)

Reza Zolfaghari und Michael Baumgartner konzentrieren sich mit ZebraCat in Berlin auf die „Prompt-to-Video“-Revolution. Ihr Modell ermöglicht es Creator*innen, durch einfache Textbeschreibungen komplexe Video-Narrative inklusive Schnitt zu generieren. Als Absolventen von Entrepreneur First verkörpern sie die neue Generation von KI-Tools, die den kreativen Prozess radikal beschleunigen.

Internationaler Ausblick & Fazit

Der Blick auf die globale Makroebene zeigt, dass die europäische Creator Economy erst am Anfang einer tiefgreifenden Umwälzung steht. Aus Asien schwappt die nächste Evolutionsstufe der Live-Commerce-Infrastruktur herüber, während in den USA autonome KI-Agenten bereits die Verhandlungen komplexer Marken-Deals übernehmen. Für den europäischen Markt bedeutet dies: Wer heute noch isolierte Content-Tools baut, wird den Anschluss an den Handel verlieren. Die Zukunft gehört jenen Plattformen, die den gesamten Workflow vom ersten Frame bis zum finalen Checkout digitalisieren.

Das Fazit für Gründer*innen und Investor*innen: Die Creator Economy ist kein flüchtiger Trend mehr, sondern das Betriebssystem des modernen Mittelstands. Wer die Souveränität über die eigene Technologie und die eigenen Daten besitzt, wird die Medienhäuser und Handelskonzerne von morgen führen.