Aktuelle Events

VEGCRAVER - die vegane Catering-App

Roxy Velez und David Heidrich launchen eine vegane Catering-App – eine Erfolgsstory im Lockdown.

Noch vor kurzem war die Suche nach einem veganen Catering eine größere Herausforderung: „Die Anzahl und Vielfalt veganer Gastrounternehmen ist in den letzten Jahren enorm gewachsen. Doch bei einer einfachen Google-Suche hatte man das Gefühl, dass es kaum pflanzliche Caterer gibt”, erinnert sich Roxy Velez. Dabei hat sie ganz andere Erfahrungen sammeln können. Bereits bei ihrer Hochzeit mit ihrem heutigen Geschäftspartner David Heidrich vor drei Jahren organisierte sie ein komplett pflanzliches Gourmet-Catering. Das kam bei den Gästen gut an. Seit dieser Zeit gilt Roxy als Anlaufstelle, wenn es um Empfehlungen für hochqualitatives, veganes Catering geht.

Mehr Vilefalt auf die Büfetts

Die Idee, eine Catering-Plattform mit ausschließlich veganen Caterern zu entwickeln, entstand aber erst ein Jahr später. 2019 stellte das Paar auf einer Nachhaltigkeitskonferenz überrascht fest, dass sogar hier das pflanzliche Angebot nur aus trockenen Knabberstangen und Cocktailtomaten bestand. Kurzerhand stürzten sich die beiden noch mit knurrenden Mägen in das Brainstorming. VEGCRAVER war geboren.

In der Szene verwurzelt

Roxy und David verfügen über ein großes Netzwerk in der veganen Szene. Gemeinsam führen sie das renommierte vegane Produktionsstudio Vexquisit – sie als Creative Director, er als Programmierer. Zu ihren Kunden zählt auch Beyond Meat, deren pflanzliche Burger weltweit gehypt werden. Als Insider und Experten wissen deshalb oft als Erste, wenn ein neuer Caterer auf den Markt kommt. Die Gastrounternehmen auf ihrer Plattform haben sie persönlich rekrutiert. Dieselistet nun alle veganen Caterer Berlins auf und ermöglicht es so, für jeden Anlass das passende Catering zu finden und zu buchen – ganz einfach per App.

Digitale Gastro-Power in der Krise

Aber warum lancieren die beiden Gründer eine Catering-App mitten in einer Pandemie, in der weder Veranstaltungen noch Partys möglich sind? „Wir haben diese Herausforderung als Vorteil gesehen und VEGCRAVER auf die veränderten Konsumgewohnheiten durch COVID-19 angepasst”, erklärt David, der die gesamte App selbst programmiert hat.

Digitale Dinner-Events, Business-Brunch per Zoom und Fractional Fika – neue Formate des Zusammenseins im Privaten und Beruflichen sollen sicherstellen, dass VEGCRAVER trotzdem ein Erfolg wird. VEGCRAVER erlaubt es, mit nur einer Bestellung mehrere Standorte zu beliefern, sodass alle Teilnehmer*innen digitaler Events die gleichen leckeren Gerichte genießen können.

„Wir haben die gemeinsamen Abendessen und den Austausch über vegane Köstlichkeiten mit Freunden und Kollegen vermisst. Wir wollten deshalb unbedingt einen Weg finden, dies unter den veränderten Bedingungen zu erleben”, ergänzt Roxy. Sie glaubt, dass die neuen Gewohnheiten auch nach dem Lockdown in Teilen beibehalten werden. „Gerade in einer Großstadt wie Berlin, wo die Distanzen lang sind, bietet es sich eigentlich an, Meetings ins Digitale zu verlagern.

Eventbranche im Bewusstseinswandel

Doch nicht nur deshalb glauben die beiden, dass VEGCRAVER ein Erfolg wird. „Die Pandemie hat uns vor Augen geführt, welche Konsequenzen unser Umgang mit Tieren haben kann. Immer mehr Menschen erkennen, dass eine pflanzliche Ernährung gut für die Umwelt, die Tiere und unsere Gesundheit ist”, sagt Roxy. Das Gründerpaar ist daher überzeugt, dass die Eventbranche auch nach Ende der Corona-Maßnahmen verstärkt auf die pflanzliche Nachfrage reagieren muss.

Roxy und David betonen darüber hinaus, dass ihre Angebote nicht nur für Veganer*innen gemacht seien, sondern für alle, die bei ihrer nächsten Veranstaltung mit einem erstklassigen, nachhaltigen Catering beeindrucken wollen.

Wenige Tage nach dem Launch wagt Roxy ein erstes Fazit: "Das Feedback war durchweg positiv, und wir können beobachten, wie die Community stetig wächst. Das Interesse ist – trotz Lockdown – überwältigend!" "Pflanzliche Speisen anzubieten gehört nicht nur in der Veranstaltungsbranche längst zum guten Ton", ergänzt David abschließend.

Produktivität statt Überstunden: Wie Echtzeitdaten das Finanzwesen von morgen steuern

Das KI-gestützte Fintech Embat beendet das Excel-Chaos im Treasury und macht Finanzteams mit Echtzeitdaten fit für die Zukunft.

Berlin, 28. April 2026 – Es ist ein bekanntes Bild in den Finanz- und Treasury-Abteilungen des deutschen Mittelstands: Wenn der Monatsabschluss naht oder Ad-hoc-Berichte für die Geschäftsführung benötigt werden, bleiben die Schreibtischlampen bis spät in die Nacht an. Die manuelle Zusammenführung von Daten aus unterschiedlichen Bankportalen und historisch gewachsenen Excel-Listen kostet nicht nur Nerven, sondern vor allem wertvolle Zeit.

Das schnell wachsende Fintech Embat tritt an, um genau diesen Engpass aufzulösen. André Reimers, Head of DACH, treibt diese Mission im deutschsprachigen Raum als Gesicht des Unternehmens voran. Seine Kernüberzeugung: Wer heute noch regelmäßig Überstunden machen muss, um finanzielle Transparenz zu schaffen, leidet nicht unter mangelnder Einsatzbereitschaft – er leidet unter einem strukturellen Datenproblem.

Beeindruckendes Wachstum durch das Lösen echter Pain Points

Dass der Schmerz in den Finanzabteilungen groß und der Bedarf an modernen Lösungen riesig ist, belegen die Zahlen, mit denen Embat den europäischen Markt aufrollt. Mit einem starken Kundenwachstum im deutschen Markt von über 250 Prozent im vergangenen Jahr und mittlerweile mehr als 400 mittelständischen und großen Unternehmenskunden weltweit hat sich das Fintech als fester Player etabliert. Das stetig wachsende Transaktionsvolumen von 250 Millionen Euro zeigt deutlich: Der Wechsel von fehleranfälligen Tabellen zu automatisierten Cloud-Lösungen ist in vollem Gange.

Der Weg aus der Excel-Falle

Mit seiner Technologie nimmt Embat den Kampf gegen ineffiziente Prozesse im Treasury auf. Anstatt hochqualifizierte Mitarbeiter mit repetitiver Datenpflege zu binden, automatisiert das System die Konsolidierung aller relevanten Finanzdaten.

„Die Erwartungshaltung, dass komplexe Finanzanalysen zwingend mit langen Abenden im Büro einhergehen müssen, ist schlichtweg nicht mehr zeitgemäß“, erklärt André Reimers. „Wenn Cashflow, Liquidität und Runways per Knopfdruck in Echtzeit abrufbar sind, ändert sich die gesamte Arbeitsdynamik. Finanzteams können aus dem reaktiven Modus heraustreten und sich auf die strategische Steuerung des Unternehmens konzentrieren.“

Hohe Innovationskraft trifft auf lokales DACH-Verständnis

Embat profitiert von einer enormen Innovationsgeschwindigkeit und Agilität, auf der die starke technologische Basis des Unternehmens beruht. Wie diese passgenau auf die spezifischen Bedürfnisse des deutschen Marktes übersetzt wird und für eine hohe lokale Marktpräsenz sorgt, zeigt André Reimers an den Standorten in München und Berlin.

Von diesen beiden Standorten aus steuert André Reimers das DACH-Geschäft und stellt das tiefe Verständnis für die komplexen Strukturen und hohen Sicherheitsbedürfnisse des deutschen Mittelstands sicher. Das Team zeigt dabei, wie moderne, dezentrale Zusammenarbeit erfolgreich funktioniert. Das Vertrauen der stetig wachsenden deutschen Kundenbasis fußt dabei auf dieser geballten lokalen Expertise gepaart mit der unerschütterlichen Zuverlässigkeit der Systeme.

Führen durch Resultate, nicht durch Anwesenheit

Die Botschaft an die Finanzwelt ist klar: Moderne Führung, hohe Produktivität und Skalierbarkeit erfordern keine starren Kontrollmechanismen oder endlosen Arbeitstage. Sie erfordern radikale Datentransparenz und die richtigen digitalen Werkzeuge. Wenn die Daten in Echtzeit fließen, sinkt die Fehlerquote, die Entscheidungsgeschwindigkeit steigt – und die systembedingten Überstunden im Treasury gehören endgültig der Vergangenheit an.

Über Embat:

Embat ist ein KI-gestütztes FinTech mit Schwerpunkt auf Treasury-Management, das es mittelständischen Unternehmen und Großkonzernen ermöglicht, ihre Finanzprozesse in Echtzeit zu zentralisieren. Gegründet von Antonio Berga und Carlos Serrano – ehemaligen J.P. Morgan-Managern mit umfassender Erfahrung im Corporate Banking – sowie Tomás Gil, dem ehemaligen CTO von Fintonic, entstand die Plattform mit der Mission, die Finanzabteilung zu digitalisieren. Die klare Prämisse dabei: Technologie von Finanzexperten für Finanzexperten.

Durch seine hybride Konnektivität lässt sich Embat in über 15.000 Banken und führende ERP-Systeme integrieren und beseitigt so jegliche Datenfragmentierung. Das wichtigste Alleinstellungsmerkmal ist TellMe, ein „Agentic Treasury Analyst“ (autonomer KI-Analyst), der Cashflow-Muster erkennt, komplexe Kontenabstimmungen automatisiert und strategische Entscheidungen zur Optimierung der Liquidität vorschlägt.

Mit Niederlassungen in Madrid, London, Berlin und München definiert Embat die Zukunft des Corporate Finance neu.

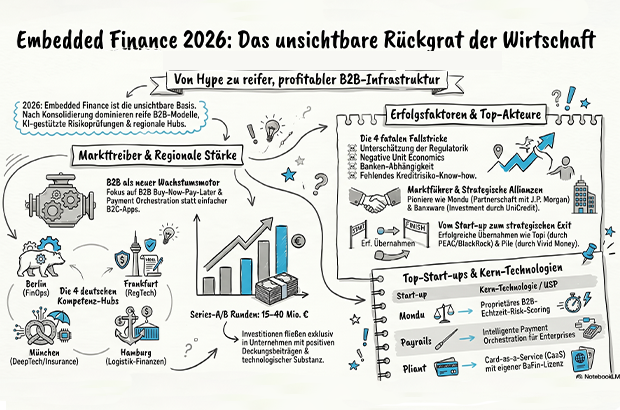

Embedded-Finance-Start-up-Report 2026

Der unsichtbare Bankensektor: Wie Embedded Finance und die dazugehörigen Start-ups die Wirtschaft des Jahres 2026 prägen.

Einst war es das große Versprechen für eine Handvoll hipper Neobanken, heute ist es das unsichtbare Rückgrat der europäischen Wirtschaft: Embedded Finance. Im Jahr 2026 wird das Marktwachstum längst nicht mehr von der fixen Idee isolierter Bank-Apps dominiert, denn jedes zukunftsorientierte Unternehmen ist mittlerweile selbst zu einem/einer Finanzdienstleister*in geworden. Ob Software-as-a-Service-Anbieter*in, Logistik-Plattform oder Marktplatz – die nahtlose Integration von Zahlungen, Krediten und Versicherungen in nicht-finanzielle Kund*innenreisen ist das neue Paradigma.

Dieser Report beleuchtet eine Branche, die den „Sturm der Konsolidierung“ überlebt hat und nun mit reifen Geschäftsmodellen und echten Profiten die Architektur der modernen Wirtschaft neu programmiert.

Vom Hype zur fundamentalen Reife

Nach den massiven Zinsanpassungen und regulatorischen Aufräumarbeiten der Jahre 2023 und 2024 zeichnet der Embedded-Finance-Markt heute ein Bild robuster Reife. Renommierte Analystenhäuser wie Bain & Company und Dealroom haben diese Entwicklung früh vorgezeichnet: Der globale Markt für Embedded-Finance-Dienstleistungen hat sich in ein Multimilliarden-Segment verwandelt, dessen europäisches Transaktionsvolumen mittlerweile signifikante Teile des digitalen B2B- und B2C-Handels stützt. Der technologische Haupttreiber dieser neuen Ära ist unbestreitbar die künstliche Intelligenz, genauer gesagt proprietäre Machine-Learning-Modelle, die Risikobewertungen in Millisekunden durchführen und Transaktionsströme dynamisch optimieren. Investor*innen honorieren diese technologische Tiefe: Wir sehen heute höchst realistische Series-A- und Series-B-Runden im Bereich von 15 bis 40 Millionen Euro für Start-ups, die nachweislich positive Deckungsbeiträge aufweisen. Es fließt wieder signifikant Kapital, doch es fließt exklusiv in Substanz und Skalierbarkeit, nicht mehr in reines Marketing.

Die neuen Treiber: B2B, Vertikalisierung und Orchestrierung

Wenn man über das Offensichtliche wie einfache White-Label-Kreditkarten hinausblickt, dominieren im Jahr 2026 drei spezifische Sub-Sektoren den Markt. Allen voran steht B2B Buy-Now-Pay-Later, eine Disziplin, die das traditionelle, schwerfällige Factoring abgelöst hat und nun direkt in B2B-Checkouts und Beschaffungsnetzwerke integriert ist. Ein weiterer massiver Treiber ist die sogenannte Payment Orchestration für vertikale SaaS-Lösungen. Hier werden komplexe, branchenspezifische Zahlungsflüsse – etwa im Handwerk oder in der Gastronomie – automatisiert im Hintergrund abgewickelt. Zuletzt etabliert sich Embedded Insurance zunehmend im Industriekontext, wo Maschinen nicht mehr nur geleast, sondern im selben Atemzug transaktionsbasiert versichert werden. Pioniere wie die Berliner Mondu oder auch europäische Schwergewichte wie Swan haben den Weg für diese hochspezialisierten Infrastruktur-Layer geebnet und gezeigt, wie tiefgreifend diese Geschäftsmodelle in die Wertschöpfungsketten der Realwirtschaft eingreifen.

Die Lektionen der BaaS-Krise

Doch dieser Reifegrad wurde teuer erkauft. Der Beinahe-Kollaps des britischen Banking-as-a-Service-Pioniers Railsr und die drastischen BaFin-Sonderprüfungen samt Wachstumsbeschränkungen bei etablierten deutschen Playern wie Solaris in den Jahren zuvor haben den Markt fundamental erschüttert. Der Traum, Finanzdienstleistungen wie einfache Legosteine zusammenzustecken, kollidierte brutal mit der harten Realität des Bankwesens.

Aus diesen gescheiterten Hoffnungen lassen sich für heutige Gründer*innen vier konkrete, fatale Fallstricke ableiten. Der erste und wichtigste ist die eklatante Unterschätzung der Regulatorik; Compliance lässt sich nicht auslagern, und Aufsichtsbehörden dulden keine agilen Versuch-und-Irrtum-Prozesse bei der Geldwäscheprävention. Der zweite Fallstrick ist die Falle der negativen Unit Economics im B2C-Sektor, wo exorbitante Kund*innenakquisitionskosten oft nur durch kontinuierliches VC-Geld gedeckt wurden. Drittens das Klumpenrisiko der Abhängigkeit von einer einzigen Partnerbank, deren Ausfall das eigene Start-up über Nacht handlungsunfähig macht. Und viertens die Fehlannahme, dass Technologie allein ausreicht; wer heute kein tiefes Verständnis für klassisches Bilanzstruktur- und Kreditrisikomanagement mitbringt, scheitert unweigerlich.

Das deutsche Netzwerk: Die Schmieden der Infrastruktur

Deutschland hat sich in dieser Konsolidierungsphase als einer der resilientesten Standorte in Europa bewiesen, getragen von vier essenziellen Hubs. Berlin verteidigt dabei seinen Status als unangefochtene Hauptstadt für FinOps und B2B-Zahlungsinfrastruktur, massiv befeuert durch die Talent-Pipelines der TU Berlin sowie das dichte Netzwerk an Serial Entrepreneurs aus der N26- und SumUp-Schule. Frankfurt am Main bildet den unverzichtbaren regulatorischen Gegenpol; hier, im Schatten von EZB und BaFin, entstehen im Umfeld des TechQuartiers und der Frankfurt School of Finance and Management jene Start-ups, die komplexe Compliance- und Treasury-Architekturen für Großbanken bauen. München dominiert den Bereich DeepTech und Embedded Insurance im industriellen B2B-Kontext, was auf die herausragende Stellung des Center for Digital Technology and Management (CDTM) und die enge Verzahnung mit der ansässigen Versicherungs- und Automobilindustrie zurückzuführen ist. Hamburg schließlich hat sich als europäischer Hotspot für Trade Finance und in Logistikketten eingebettete Finanzierungen etabliert, gestützt durch die traditionelle Stärke der Hansestadt im globalen Handel.

Investor*innen-Radar

Das Ökosystem der Geldgeber*innen hat sich im Jahr 2026 stark differenziert und professionalisiert. An der Spitze der spezialisierten VCs agieren Fonds wie FinTech Collective und Motive Ventures (hervorgegangen aus der Übernahme des Berliner VCs embedded/capital), die mit tiefem technologischen Verständnis gezielt in Infrastruktur-Layer investieren. Unter den Top-Tier Generalisten ragen Cherry Ventures, Earlybird und Point Nine heraus, die insbesondere Series-A-Runden bei überzeugenden B2B-SaaS-Modellen anführen.

Ein starker Motor sind zudem Corporate VCs und bankennahe Fonds geworden: CommerzVentures, als unabhängiger Player, treibt Themen wie Climate-Fintech massiv voran, während CVCs der Realwirtschaft wie Allianz X und Porsche Ventures strategisch in Start-ups investieren, die sich nahtlos in ihre eigenen vertikalen Ökosysteme einklinken lassen. In der kritischen Frühphase wird der Markt von einer hochgradig vernetzten Gruppe aus Business Angels angetrieben, die nicht nur erstes Kapital, sondern vor allem regulatorisches Know-how und entscheidende Bankennetzwerke einbringen

Die Top Start-ups (Must-Watch)

Für die nachfolgende Liste der Must-Watch-Unternehmen haben wir strikte Kriterien angelegt. Die Auswahl basiert auf nachgewiesener Marktrelevanz durch echte Kund*innenimplementierungen, einem hohen technologischen Reifegrad und einem diversifizierten Ansatz bei der Lösung komplexer Finanzinfrastrukturprobleme. Zudem war ein nachhaltiges Investoren-Vertrauen in den letzten zwölf Monaten ein Schlüsselfaktor. Wir beleuchten hierbei ausschließlich Start-ups mit Hauptsitz in Deutschland, deren Gründung im Jahr 2020 oder später erfolgte, um die wahre nächste Generation der Branche abzubilden.

Banxware

Das 2020 von Miriam Wohlfarth und Jens Röhrborn gegründete Banxware hat sich als Marktführer für Embedded Lending in Deutschland etabliert. Banxware bietet eine White-Label-Lösung, mit der Marktplätze und Zahlungsdienstleister*innen ihren Händler*innen Sofortkredite basierend auf historischen Umsatzdaten anbieten können. Der USP liegt in der extrem schnellen Risikoprüfung und der nahtlosen API-Integration in bestehende Plattformen. Das enorme Vertrauen der Finanzbranche in dieses Modell spiegelt sich massiv auf Investor*innenseite wider: Neben frühen Leadern wie Element Ventures (heute 13books Capital) ist insbesondere der Einstieg der Großbank UniCredit ein Ritterschlag. Die Bank führte nicht nur die Series-A-Runde an, sondern legte Mitte 2025 mit einem weiteren strategischen Millionen-Investment nach, um die europäische Expansion von Banxware gemeinsam voranzutreiben.

Pliant

Im Jahr 2020 von Malte Rau und Fabian Terner aus der Taufe gehoben, definiert Pliant den Markt für B2B-Kreditkarten und Ausgabenmanagement neu. Das B2B-SaaS-Modell kombiniert eine moderne Karteninfrastruktur mit einer tiefen API-basierten Integration in Buchhaltungs- und ERP-Systeme. Der technologische Vorsprung liegt im eigenen Card-as-a-Service-Angebot (CaaS), das anderen B2B-Plattformen den Launch eigener Kreditkartenprogramme ermöglicht. Ein entscheidender Meilenstein war hierfür der Erhalt der eigenen E-Geld-Lizenz der BaFin, die Pliant die nötige regulatorische Unabhängigkeit verleiht. Unterstützt wird Pliant von namhaften Investoren wie SBI Investment, Alstin Capital – und einem Investment des globalen Schwergewichts PayPal Ventures, das das enorme Skalierungspotenzial der Plattform bestätigt.

Mondu

Die Serial Entrepreneurs Malte Huffmann, Philipp Povel und Gil Danziger gründeten Mondu 2021 und revolutionieren damit den B2B-Zahlungsverkehr. Ihr B2B-BNPL-Modell ermöglicht es Geschäftskund*innen, online wie B2C-Kund*innen auf Rechnung oder in Raten zu kaufen, während der Händler sofort sein Geld erhält. Die Kerntechnologie ist ein proprietäres Echtzeit-Risk-Scoring für Firmenkund*innen. Finanziert wurde diese Vision anfangs von Top-Tier-Fonds wie Valar Ventures und Cherry Ventures. Der ultimative Ritterschlag erfolgte jedoch Ende 2025: Neben dem Erhalt der E-Geld-Lizenz sicherte sich Mondu eine 100-Millionen-Euro-Fazilität von J.P. Morgan Payments inklusive einer strategischen Partnerschaft, um die Buy-Now-Pay-Later-Lösung dem europäischen Kund*innen stamm der US-Großbank anzubieten.

Payrails

Gegründet 2021 von Orkhan Abdullayev, Emre Talay und Nicolas Thouzeau, löst Payrails die Herausforderung der Payment Orchestration. Das FinOps-Start-up baut ein intelligentes Betriebssystem für Zahlungen, das Transaktionen für Enterprise-Kund*innen dynamisch über verschiedene Provider routet, um Kosten zu senken und Autorisierungsraten zu maximieren. Die technologische Brillanz dieser Architektur lockte früh Schwergewichte wie Andreessen Horowitz und EQT Ventures an. Im Sommer 2025 zündete Payrails die nächste Stufe: HV Capital führte eine massive Series-A-Runde über 32 Millionen US-Dollar an, bei der auch alle Top-Tier-Altinvestoren erneut mitzogen, um die globale Expansion der Plattform endgültig zu sichern.

Finmid

Die beiden N26-Alumni Max Schertel und Alexander Talkanitsa starteten Finmid 2021 mit der Mission, jede B2B-Plattform zu einer Finanzierungsquelle zu machen. Ihr Geschäftsmodell fokussiert sich auf Embedded B2B Lending, das speziell auf die Anforderungen von Marktplätzen (wie etwa dem Partner Wolt) zugeschnitten ist – ohne dass diese Plattformen eigenes Kapital bereitstellen oder Risiken tragen müssen. Ihr USP ist die radikale Simplifizierung der B2B-Kreditvergabe durch smarte Echtzeit-Datenverknüpfungen. Angetrieben von einer wuchtigen 23-Millionen-Euro-Series-A-Runde, angeführt vom britischen Fonds Blossom Capital und dem Seed-Lead Earlybird, treibt das Start-up seine aggressive europäische Expansion unaufhaltsam voran.

Topi (Exit)

Charlotte Pallua und Estelle Merle brachten Topi 2021 an den Start, um das Hardware-as-a-Service-Modell in den B2B-Bereich zu integrieren. Über die Plattform können B2B-Kund*innen IT-Equipment flexibel mieten, wobei Topi den gesamten Prozess vom Checkout über das Refinancing bis zum Asset-Management abwickelt. Nachdem Topi mit Händler*innen wie Cyberport massiv skalierte und von Top-VCs wie Index Ventures und Creandum finanziert wurde, erfolgte im Sommer 2025 der strategische Exit: Das FinTech wurde von dem internationalen Leasing-Giganten PEAC Solutions (einem BlackRock-Portfoliounternehmen) übernommen, um das innovative B2B-Mietmodell global in dessen gewaltige Finanzierungsinfrastruktur einzugliedern.

Hakuna

Im Bereich Embedded Insurance schlägt das 2021 von Sebastian Jost, Rupert Mayer und Orhan Köroglu gegründete Hakuna neue Wege ein. Das Start-up bietet Händler*innen eine Plattform für Garantieverlängerungen und Produktschutzversicherungen, nahtlos integriert in den Online- und Offline-Checkout. Der USP ist ein völlig neu gedachtes, digitales Schadensmanagement, das die Abwicklung für Endkund*innen radikal vereinfacht. Finanziert von Top-VCs wie Earlybird und Visionaries Club, hat Hakuna mittlerweile den Sprung ins absolute Enterprise-Segment geschafft: Im Jahr 2025 integrierten Branchenriesen wie Vorwerk, STIHL und Mister Spex die Embedded-Technologie des Start-ups, um ihre eigenen, maßgeschneiderten Produktschutzprogramme europaweit zu skalieren.

Pile (Exit)

Jessica Holzbach startete Pile 2022 und pivotierte das Modell nach dem Krypto-Winter erfolgreich zu einem hochspezialisierten Treasury-Angebot für Start-ups. Die B2B-SaaS-Technologie bündelte Konten und automatisierte die Diversifikation von Einlagen zur Risikominimierung. Das Modell erregte schnell Aufmerksamkeit und führte bereits im Sommer 2024 zu einem frühen Exit: Die 2019 gegründete Berliner Neobank Vivid Money übernahm das Start-up, um das eigene Business-Banking-Angebot mit Piles Treasury-Technologie aufzurüsten – ein Paradebeispiel für die rasante Konsolidierung im FinTech-Infrastrukturmarkt.

Internationaler Ausblick & Fazit

Blickt man über die Grenzen Europas hinaus, formen sich 2026 drei gewaltige Makro-Trends, die den deutschen Markt unausweichlich verändern werden. Aus Asien schwappt die Architektur für grenzüberschreitende Echtzeit-Settlements basierend auf regulierten Stablecoins und digitalen Zentralbankwährungen heran, was das traditionelle Korrespondenzbankensystem massiv unter Druck setzt. Die USA hingegen dominieren die Entwicklung der KI-gesteuerten autonomen Finanzen, bei der das Corporate Treasury von Algorithmen gesteuert wird, die ohne menschliches Zutun Liquidität verschieben. Aus Indien lernen wir, wie Identity-as-a-Service untrennbar mit dem Zahlungsverkehr verschmilzt und Betrug nahezu ausmerzt.

Für Gründer*innen und Investor*innen im DACH-Raum bedeutet dies: Der Fokus muss radikal auf Profitabilität, wasserdichter Compliance und extrem stabiler Infrastruktur liegen. Wer heute in Embedded Finance gewinnt, baut keine bunten Apps mehr, sondern die hochkomplexen, unsichtbaren Stahlträger der digitalen Weltwirtschaft.

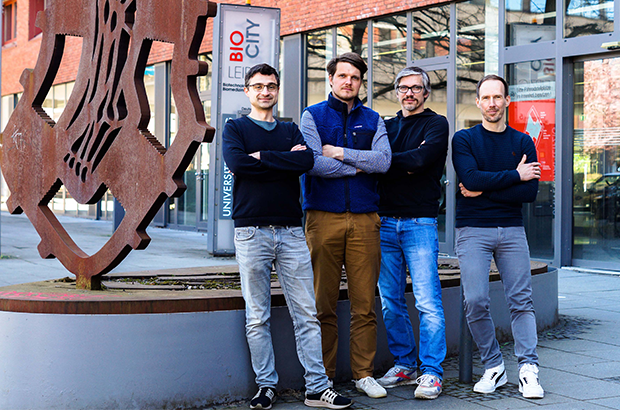

ESTER Biotech: Vom Friedhofskompost zur Plastik-Revolution

Ein Enzym vom Leipziger Südfriedhof soll das weltweite Plastikproblem lösen. Das 2025 als Uni-Spin-off gegründete Start-up ESTER Biotech verspricht, schwer recycelbares PET in Rekordzeit in seine Grundbausteine zu zerlegen. Doch auf dem Weg vom Labor in die industrielle Skalierung warten das berüchtigte „Valley of Death“ – und ein scheinbar übermächtiger Konkurrent.

Der Ursprung einer potenziellen industriellen Revolution liegt ausgerechnet auf einem Komposthaufen des Leipziger Südfriedhofs. Hier suchten Forschende der Universität Leipzig gezielt nach Mikroorganismen zur Zersetzung pflanzlicher Biopolymere und stießen auf das Enzym PHL7. Was in vielbeachteten Publikationen begann, mündete im Frühjahr 2025 in der offiziellen Ausgründung der ESTER Biotech GmbH.

Das Gründer-Quartett um die Geschäftsführer Dr. Ronny Frank und Martin Hirschfeld, den wissenschaftlichen Kopf Dr. Christian Sonnendecker (der das Enzym maßgeblich mitentdeckte) sowie den verfahrenstechnischen Leiter Madalin Ceausescu hat ein klares Ziel: das chemisch-biologische Recycling von Kunststoffen auf ein neues Level zu heben. Möglich machte diesen Schritt eine millionenschwere exist-Forschungstransfer-Förderung.

Für klassische Investor*innen sei die frühe Laborphase technologisch meist noch zu riskant, erklärt Christian Sonnendecker. Genau hier setzte das Programm an: „Der exist-Forschungstransfer hat für uns die Lücke zwischen akademischem Proof-of-Concept und einem investierbaren DeepTech-Start-up geschlossen“, betont der Gründer. „Wir konnten den Recyclingprozess vom Labormaßstab von einem Liter auf 100 Liter skalieren, neue Konzepte realisieren und das Verfahren validieren.“

Was passiert im Bioreaktor mit schmutzigem Müll?

Das technologische Versprechen ist enorm: Das modifizierte Enzym zerlegt selbst schwer recycelbares PET – wie Multilayer-Verpackungen – bei moderaten 65 Grad Celsius und Reaktionszeiten von unter 6 Stunden. Daraus kann neuwertiges, lebensmittelechtes Plastik entstehen. Doch wie reagiert das System in der Realität auf stark kontaminierten Haushaltsmüll? „Wir haben bislang keinen echten Show-Stopper gesehen“, sagt Sonnendecker pragmatisch. Er verzichtet auf romantische Labor-Illusionen und ordnet die Fakten nüchtern ein: „Enzyme gelten als empfindlich, aber in der Praxis arbeiten sie erstaunlich resilient. In den typischen Abfallfraktionen, die wir getestet haben, führen Störstoffe aus Haushaltsverpackungen nicht zu kritischen Aktivitätsverlusten.“

Der tatsächliche Flaschenhals sei nicht die Biologie, sondern die Wirtschaftlichkeit: „Je stärker eine Abfallfraktion kontaminiert ist, desto geringer die Ausbeuten, begleitet mit höherem Aufwand bei Aufarbeitung und Reinigung der Produkte. Das erhöht die Kosten.“

Ein patentierter Moat – mehr als nur ein KI-Hype

Um die Enzyme rasant an neue Herausforderungen anzupassen, nutzt ESTER eine patentierte, KI-gestützte Screening-Technologie. Ist das ein echter Schutzwall gegen gut finanzierte BioTech-Labore in Asien oder den USA? Sonnendecker relativiert den reinen Algorithmus-Hype mit einem treffenden Vergleich: „KI ist heute kein exklusives Werkzeug mehr. Als Schreiben zugänglich wurde, bedeutete das nicht, dass plötzlich jeder ein guter Autor war.“

Der wahre Moat („Burggraben“) liege vielmehr in der eigenen Hardware und der Datenqualität: „Unser patentierter Ansatz basiert auf einer Messmethode, die den Kunststoff mittels Elektrizität selbst beobachtet. Dadurch erhalten wir multiparametrische und hochqualitative Daten. Der eigentliche Moat entsteht deshalb nicht durch ein einzelnes ‚Superenzym‘, sondern durch die integrierte Plattform und den Blick auf das Große.“

Regulatorik als Treiber

Der globale Markt für recyceltes PET (rPET) wird aktuell auf rund 5 Millionen Tonnen beziffert. Angetrieben wird das Wachstum durch strenge EU-Vorgaben (PPWR), die ab 2026 greifen und das Ende des billigen Neu-Plastiks einläuten. Aber was passiert, wenn Plastik aus Erdöl politisch geduldet und weiterhin deutlich billiger bleibt? „Natürlich ist Neu-Plastik aus Erdöl in vielen Fällen günstiger“, räumt Sonnendecker ein. „Aber dieser Preisvorteil basiert auf einer von fossilen Ressourcen abhängigen, linearen Wertschöpfungskette – also einer Sackgasse.“

Deutlicher wird der Gründer beim Blick auf die Konkurrenz. Der französische Marktführer Carbios bindet bereits Giganten wie L'Oréal oder Nestlé an sich. Droht ESTER den Anschluss zu verlieren? „Wir beäugen die Entwicklung von Carbios mit Skepsis“, teilt Sonnendecker selbstbewusst aus.

Tatsächlich geriet der Branchenprimus zuletzt ins Straucheln: Anfang 2025 kündigte Carbios einen drastischen Stellenabbau an, der Bau der ersten industriellen Anlage im französischen Longlaville musste aus Finanzierungsgründen auf 2028 verschoben werden. Stattdessen fokussieren sich die Franzosen nun auf ein Joint Venture mit dem chinesischen PET-Hersteller Wankai, um ab 2026 eine Anlage in Asien hochzuziehen.

Für Sonnendecker ein klares strategisches Warnsignal: „Wir sehen hier die Gefahr, dass europäische Technologie abwandert und genau jene industrielle Resilienz in Europa nicht entsteht, die so wichtig für unsere Unabhängigkeit wäre.“ Der Mitgründer ergänzt: „Weiterhin geht uns Carbios nicht weit genug, denn die Technologie bietet noch viel mehr. Wir konzentrieren uns gezielt auf bislang nicht verwertbare PET-Ströme, die heute in der Verbrennung landen und wollen in Synergie mit mechanischen Recyclern gehen. Und dabei ist PET nur der Anfang: Unser Ziel ist es, aktiv die Kunststoffwelt von morgen mitzugestalten, indem wir unsere Technologien bei der Entwicklung neuer Kunststoffe nach dem Prinzip Design for Circularity ins Spiel bringen. Wir setzen dabei auf die Werkzeuge der Natur, Enzyme, um zukunftsfähige Lösungen skalierbar zu machen und der nächsten Generation von Kunststoffen den Weg in den Markt zu ebnen.“

Die unweigerliche Millionenfrage

ESTER positioniert sich als Angreifer, doch im Jahr 2026 beginnt die kritische Phase. Der Sprung in den industriellen Dauerbetrieb ist in der Biotechnologie historisch extrem kapitalintensiv – das klassische „Valley of Death“. Da die öffentlichen Fördermittel auslaufen, sind nun echte Venture-Capital-Millionen gefragt. Wie will das Start-up überleben, ohne direkt die Mehrheit an Großinvestor*innen abgeben zu müssen?

„Für uns ist entscheidend, nicht in die klassische Falle zu laufen, alles auf eine kapitalintensive eigene Anlage zu setzen“, erklärt der Gründer seine Strategie. Demonstrations- und Pilotanlagen würden lieber angemietet statt selbst gebaut. „Das reduziert den Kapitalbedarf in dieser kritischen Phase erheblich.“ Für die anstehenden Verhandlungen mit großen VC-Fonds zeigt er sich kompromisslos: „Wir kommen nicht aus einer Position des Zwangs, sondern mit validierter Technologie, ersten Umsätzen, starken Partnern und klaren Skalierungspfaden.“

Ist Florian Bretschneider seriös? Kundenberichte, Bewertungen und Hintergrund Einleitung

Wer sich über Online-Business oder neue digitale Tätigkeiten informiert, möchte häufig vorab einschätzen, wie seriös ein Anbieter ist und welche Erfahrungen andere gemacht haben. Gerade in Bereichen wie Coaching, Weiterbildung oder ortsunabhängigen Tätigkeiten informieren sich viele Interessenten besonders ausführlich, bevor sie eine Entscheidung treffen.

Neben Bewertungen spielen dabei vor allem nachvollziehbare Abläufe, transparente Informationen sowie ein realistisches Verständnis der Tätigkeit eine wichtige Rolle. Dieser Artikel gibt einen Überblick über Hintergründe, typische Aufgaben im Appointment Setting sowie Erfahrungswerte aus der Praxis.

Welche Tätigkeit steckt hinter Appointment Setting?

Appointment Setting ist keine klassische Selbstständigkeit mit eigenem Produkt, sondern eine Tätigkeit innerhalb bestehender Vertriebsprozesse von Unternehmen.

Typische Aufgaben sind:

- Bearbeitung eingehender Anfragen über digitale Kanäle anhand klar definierter Abläufe

- Einordnung, ob Anfragen grundsätzlich zum jeweiligen Angebot passen (Vorqualifizierung)

- Koordination und Terminvereinbarung für Beratungsgespräche innerhalb bestehender Systeme

- Unterstützung im Vertriebsprozess durch strukturierte Vorbereitung von Gesprächsterminen

Die Tätigkeit folgt in der Praxis meist strukturierten Prozessschritten, damit Anfragen nachvollziehbar eingeordnet und Termine sinnvoll koordiniert werden können.

Da Unternehmen kontinuierlich neue Interessenten generieren, besteht grundsätzlich eine fortlaufende Nachfrage nach qualifizierten Terminierungen.

Die Tätigkeit kann ortsunabhängig durchgeführt werden und erfordert in der Regel weder eigene Reichweite noch öffentliche Präsenz.

Beispiele für Erfahrungen aus der Praxis

Einige Erfahrungsberichte beziehen sich auf erste praktische Schritte im Bereich digitaler Terminierungsprozesse. Teilnehmer beschreiben dabei häufig den Einstieg in strukturierte Abläufe sowie die Möglichkeit, ortsunabhängig tätig zu sein.

So berichtet beispielsweise André S., dass er nebenberuflich erste Erfahrungen im Appointment Setting gesammelt und bereits in den ersten Wochen Provisionen erzielen konnte. Auch Teilnehmer wie Alice Z. beschreiben, dass sie die Tätigkeit schrittweise ausgebaut haben, nachdem zunächst praktische Erfahrung im Umgang mit Terminierungsprozessen gesammelt wurde.

Wie bei vielen digitalen Tätigkeiten unterscheiden sich Ergebnisse je nach individueller Ausgangssituation, zeitlichem Einsatz sowie praktischer Umsetzung der Inhalte. Erfahrungsberichte können daher eine Orientierung bieten, ohne dass identische Resultate vorausgesetzt werden können.

Einordnung von Erfahrung und Bewertungen

Florian Bretschneider beschäftigt sich seit mehreren Jahren mit digitalen Vertriebsprozessen und Appointment Setting im Coaching- und Beratungsumfeld. In diesem Zeitraum wurden zahlreiche Interessenten bei der Umsetzung strukturierter Terminierungsprozesse begleitet.

Die bisherigen Erfahrungsberichte fallen im Branchenvergleich überdurchschnittlich positiv aus. Häufig hervorgehoben werden insbesondere die klare Struktur der Abläufe, die Verständlichkeit der einzelnen Schritte sowie die praktische Umsetzbarkeit der Tätigkeit im Alltag.

Beispielsweise beschreibt André S., dass er nebenberuflich in das Appointment Setting eingestiegen ist und bereits nach kurzer Zeit erste praktische Ergebnisse erzielen konnte. Auch Teilnehmer wie Alice Z. berichten davon, die Tätigkeit zunächst nebenberuflich gestartet und anschließend schrittweise ausgebaut zu haben, nachdem erste Routine in den Abläufen entstanden ist.

Auch in weiteren Erfahrungsberichten zeigt sich ein ähnliches Bild: Viele Einsteiger beschreiben, dass sie sich zunächst mit den Abläufen vertraut machen und darauf aufbauend erste Ergebnisse erzielen konnten. Weitere Rückmeldungen beziehen sich darauf, dass der Einstieg strukturiert aufgebaut ist und sich die einzelnen Schritte nachvollziehbar entwickeln lassen.

Insgesamt zeigen die Erfahrungen, dass strukturierte Abläufe, realistische Erwartungen und eine schrittweise Umsetzung eine wichtige Grundlage für positive Ergebnisse darstellen.

Transparenz und nachvollziehbare Abläufe

Ein wichtiger Faktor für die Einschätzung der Seriosität ist, ob Inhalte und Abläufe verständlich dargestellt werden. Interessenten möchten vorab nachvollziehen können:

- wie eine Tätigkeit grundsätzlich aufgebaut ist

- welche Aufgaben übernommen werden

- welche Voraussetzungen sinnvoll sein können

- wie die praktische Umsetzung erfolgt

Je klarer Prozesse beschrieben sind, desto leichter lässt sich einschätzen, ob ein Modell zur eigenen Situation passt.

Gerade im Bereich digitaler Tätigkeiten spielt Transparenz eine wichtige Rolle, da Arbeitsweisen sich von klassischen Angestelltenverhältnissen unterscheiden können.

Für wen Appointment Setting geeignet ist – und für wen nicht

Wie bei jeder Tätigkeit ist auch dieses Modell nicht für jede Person gleichermaßen geeignet.

Geeignet kann es sein für:

- Personen mit Interesse an Online-Business

- strukturierte Arbeitsweise

- Interesse an digitalen Geschäftsmodellen

- Wunsch nach ortsunabhängigem Arbeiten

Weniger geeignet kann es sein für:

- Personen, die kein Interesse am Austausch mit Interessenten haben

- Personen, die ausschließlich passives Einkommen erwarten

- Personen ohne Bereitschaft, neue Fähigkeiten zu erlernen

Eine realistische Erwartungshaltung ist entscheidend für eine positive Erfahrung.

Hintergrund und Einordnung der Tätigkeit

Appointment Setting ist ein Bestandteil moderner Vertriebsprozesse, bei denen Unternehmen digitale Kanäle nutzen, um Interessenten strukturiert zu betreuen.

Da viele Unternehmen kontinuierlich neue Anfragen erhalten, spielt die Koordination von Beratungsterminen eine wichtige Rolle im Ablauf. Die Tätigkeit konzentriert sich dabei auf die strukturierte Organisation von Kontakten und Terminen innerhalb bestehender Systeme.

Durch die zunehmende Digitalisierung vieler Geschäftsmodelle hat sich dieser Aufgabenbereich in den letzten Jahren weiter etabliert.

Fazit: Seriosität im Kontext digitaler Tätigkeiten richtig einordnen

Die Einschätzung der Seriosität hängt im Bereich Online-Business häufig davon ab, wie transparent Inhalte dargestellt werden und wie nachvollziehbar Abläufe aufgebaut sind.

Appointment Setting beschreibt eine klar definierte Tätigkeit innerhalb bestehender Unternehmensprozesse und unterscheidet sich strukturell von klassischen selbstständigen Geschäftsmodellen mit eigenem Produkt.

Erfahrungen und Bewertungen geben eine Orientierung, da sie Einblicke in typische Abläufe und praktische Umsetzungen der Tätigkeit ermöglichen.

Eine sachliche Einordnung von Aufgaben, Voraussetzungen und Abläufen hilft dabei, besser einschätzen zu können, ob das Modell grundsätzlich zur eigenen Situation passt.

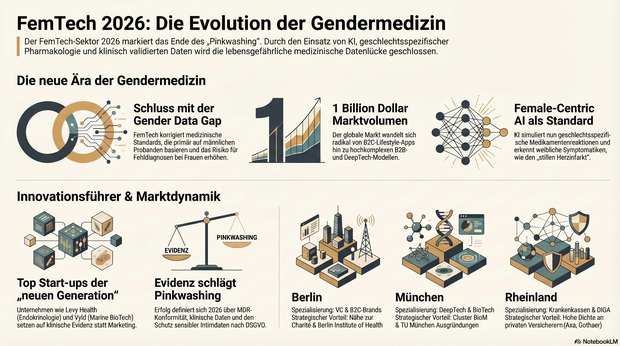

FemTech-Start-up-Report 2026

Schluss mit Pinkwashing! Wie deutsche FemTech-Start-ups 2026 die Gender Data Gap schließen und unser Gesundheitssystem neu codieren.

Lange Zeit belächelt, in eine rosarote Lifestyle-Ecke gedrängt und von männlich dominierten Investment-Komitees als Nischenthema abgetan: FemTech hat einen beispiellosen Reifeprozess hinter sich. Doch der eigentliche Paradigmenwechsel des Jahres 2026 findet tief in der Pharmakologie und der klinischen Forschung statt. Jahrzehntelang galt in der Medizin der 70 Kilogramm schwere Durchschnittsmann als universeller Standard. Die fatale Folge dieser sogenannten Gender Data Gap ist, dass Medikamente primär an männlichen Probanden getestet wurden, weshalb Frauen bis heute ein dramatisch höheres Risiko für Fehldiagnosen und schwere Nebenwirkungen tragen. Der weibliche Körper verstoffwechselt Wirkstoffe aufgrund hormoneller Zyklen und abweichender Enzymaktivitäten völlig anders. Vom einstigen Tabuthema zum DeepTech-Sektor beweist die Branche heute, dass geschlechtsspezifische Medizin kein Nischendasein mehr fristet, sondern ein systemkritisches Versäumnis korrigiert. FemTech schließt endlich diese lebensgefährliche Datenlücke und wird so zum unverzichtbaren Rückgrat einer gerechten, digitalen Medizin.

Datenpower gegen die medizinische Unsichtbarkeit

Der globale Markt für Frauengesundheit steuert laut aktuellen Analysen von McKinsey weltweit auf die Eine-Billion-Dollar-Marke zu. In Deutschland zeigt sich 2026 eine deutliche Konsolidierung. Während die Dealroom-Daten nach dem Hype der frühen 2020er Jahre zunächst eine Delle verzeichneten, hat sich das Investitionsvolumen in der DACH-Region mittlerweile auf einem konstant hohen Niveau stabilisiert. Laut einer Einschätzung der KfW fließen die Gelder heute jedoch smarter: Weg vom überfüllten B2C-Consumer-Markt, hin zu B2B-Modellen und DeepTech.

Der unangefochtene Haupttreiber in diesem Jahr ist die künstliche Intelligenz, die in der Diagnostik, bei der Mustererkennung von Biomarkern und vor allem in der Simulation geschlechtsspezifischer Medikamentenreaktionen neue Standards setzt. Series-A-Runden im zweistelligen Millionenbereich sind für wissenschaftlich validierte Geschäftsmodelle in Deutschland keine Seltenheit mehr, da die Erkenntnis gereift ist, dass eine Medizin, die die Hälfte der Menschheit ignoriert, schlichtweg ökonomisch ineffizient ist.

Gender-Pharmakologie und Female-Centric AI

Die FemTech-Welle der ersten Stunde wurde von Menstruations-Apps dominiert. Pioniere wie das Berliner Start-up Clue haben dafür den Weg bereitet. Doch 2026 dominieren völlig neue, hochkomplexe Sub-Sektoren das Feld. Erstens sehen wir einen massiven Push im Bereich der geschlechtsspezifischen Pharmakologie. Da der weibliche Metabolismus stark von Hormonzyklen beeinflusst wird, nutzen Start-ups heute synthetische Daten und KI, um virtuelle klinische Studien an weiblichen Profilen durchzuführen. Zweitens rückt die geschlechtsspezifische Kardiologie und Onkologie in den Fokus, bei der Algorithmen explizit auf weibliche Symptomatiken – wie den oft unerkannten „stillen Herzinfarkt“ bei Frauen – trainiert werden. Drittens boomt das Metabolische Biomonitoring, das präventiv Autoimmunerkrankungen trackt, die Frauen überproportional oft betreffen. Diese Entwicklung wird massiv durch Einrichtungen wie das Institut für Geschlechterforschung in der Medizin (GiM) an der Berliner Charité flankiert, das die klinische Gendermedizin maßgeblich vorantreibt.

Die Lektionen aus dem Crash der Lifestyle-Apps

Dass der Weg zur Profitabilität steinig ist, zeigte in der jüngeren Vergangenheit das spektakuläre Scheitern des US-Konzerns FemTec Health, der nach einer aggressiven Übernahmewelle – unter anderem des einstigen Schweizer Vorzeige-Start-ups Ava – grandios implodierte. Aus diesem Crash lassen sich für heutige Gründer*innen vier fatale Fallstricke ableiten. Der erste und wichtigste Fehler war die gnadenlose Unterschätzung der europäischen Medizinprodukteverordnung (MDR), die vielen Hardware-Produkten im Nachhinein das Genick brach. Zweitens offenbarten sich völlig zerstörte Unit Economics, da reine Direct-to-Consumer-Modelle durch exorbitante Marketingkosten unprofitabel wurden. Ein dritter Irrtum war das „Pinkwashing“: Es wurde mehr Budget in Lifestyle-Marketing gepumpt als in echte klinische Evidenz, was den Zugang zu essenziellen Krankenkassen-Erstattungen blockierte. Der vierte Fallstrick war die fehlende Spezialisierung auf Gender-Daten; Unternehmen, die lediglich eine weibliche Benutzeroberfläche für männliche Medizinstandards bauten, scheiterten am mangelnden medizinischen Mehrwert.

Wo die geschlechtsspezifische Innovation hierzulande pulsiert

Deutschlands FemTech-Landschaft konzentriert sich 2026 auf hochspezialisierte Hubs. Berlin bleibt der absolute Magnet für Venture Capital und B2C-Brands, stark befeuert durch die Nähe zur Charité und dem Berlin Institute of Health (BIH), das intensiv an der Schließung der Gender Data Gap arbeitet. München hat sich hingegen als das Epizentrum für DeepTech und BioTech etabliert, getragen von den exzellenten Ausgründungen der TU München und dem Cluster BioM. Ein oft unterschätzter, aber extrem relevanter Hotspot ist das Rheinland, insbesondere die Achse Köln/Bonn. Durch die hohe Dichte an privaten Krankenversicherern und Kooperationspartnern wie der Axa oder Gothaer ist dies der ideale Boden für Start-ups, die auf DiGA-Zulassungen schielen. Die Rhein-Neckar-Region um Heidelberg fungiert dank des Deutschen Krebsforschungszentrums (DKFZ) und dem Medizintechnologie-Cluster CUBEX in Mannheim als entscheidende Brücke zwischen harter Onkologie und frauenspezifischer Gesundheitsforschung.

Investor*innen-Radar

Die Investor*innenlandschaft hat sich massiv ausdifferenziert und gleicht 2026 einem hochprofessionellen Ökosystem. Auf der ersten Ebene agieren spezialisierte VCs wie der Auxxo Female Catalyst Fund oder Calm/Storm Ventures, die den Markt mit tiefer Expertise treiben. Die zweite Ebene bilden die Top-Tier Generalisten: Adressen wie Cherry Ventures, HV Capital und der spezialisierte Ableger Earlybird Health haben den ROI von FemTech längst erkannt. Drittens greifen Corporate VCs der Industrie massiv ein; hier positionieren sich Einheiten wie Bayer G4A oder der Roche Venture Fund frühzeitig, um sich strategische Innovationen im Diagnostikbereich zu sichern. Das Fundament bilden hochaktive Business Angels wie Gloria Bäuerlein, Gesa Miczaika und Startup-Verbands-Präsidentin Verena Pausder, die mit ihren Investments echte Signalwirkung erzeugen, während Syndikate wie encourageventures entscheidende Brücken in den Pre-Seed-Phasen bauen.

Die Top Start-ups (Must-Watch)

Für die folgende Auswahl der Top Start-ups des Jahres 2026 haben wir strenge Kriterien angelegt. Im Fokus stehen ausschließlich in Deutschland ansässige Unternehmen der „neuen Generation“ mit einem Gründungsjahr ab 2020. Wir bewerten die Marktrelevanz im Kontext der Gender-Medizin, den technologischen Reifegrad, das Vertrauen namhafter Lead-Investor*innen sowie die Fähigkeit, echte medizinische Datenlücken zu schließen. Die Redaktion hat diese Auswahl unabhängig und ohne finanzielle Gegenleistungen getroffen.

Levy Health (Gründung: 2021)

Das in Berlin gegründete Trio Caroline Mitterdorfer, Priv.-Doz. Dr. med. Theresa Vilsmaier und Silvia Hecher adressiert die komplexe Welt der Endokrinologie. Ihr B2B-SaaS-Produkt ist eine CE-zertifizierte Software zur klinischen Entscheidungsunterstützung, die Mediziner*innen hilft, die wahren Ursachen für weibliche Unfruchtbarkeit schneller zu entschlüsseln. Statt nur hormonelle Daten aufzubereiten, analysiert der Algorithmus umfassende klinische Parameter und Laborwerte, um eine massive diagnostische Lücke in der Reproduktionsmedizin zu schließen. Wie enorm das Skalierungspotenzial dieser Technologie ist, zeigte sich bei einer Seed-Runde über 4,5 Millionen US-Dollar: Angeführt vom US-Fonds XYZ Venture Capital und begleitet von Atlantic Labs, nutzte Levy Health das Kapital, um seinen Hauptsitz strategisch nach San Francisco zu verlegen – während Berlin die entscheidende europäische Entwicklungsbasis bleibt

Ovom Care (Gründung: 2023)

Felicia von Reden, die Gynäkologin Dr. Lynae Brayboy und die renommierte Embryologin Dr. Cristina Hickman heben die Reproduktionsmedizin mit Ovom Care auf ein neues Level. Das als Spin-off des Berliner KI-Studios Merantix gestartete Unternehmen verbindet reale physische Kinderwunschzentren – mit ersten Klinik-Standorten in Lissabon und Großbritannien – mit einer hochkomplexen Software zur Therapieplanung. Der USP: Der Algorithmus nutzt globale Patientinnendaten, um IVF-Behandlungen präzise auf den individuellen weiblichen Körper zuzuschneiden. Für diese technologische Schließung der Datenlücke sammelte das Start-up in einer Seed-Runde 4,8 Millionen Euro ein, angeführt vom Deep-Tech-VC Alpha Intelligence Capital (AIC) unter strategischer Beteiligung von Merantix und Ananda Impact Ventures.

Endo Health (Gründung: 2020)

Die Gynäkologin Dr. med. Nadine Rohloff und der Wirtschaftsinformatiker Markus Rothenhöfer (CIO) haben mit der in Chemnitz ansässigen Endo Health GmbH ein Unternehmen geschaffen, das sich lange Zeit exklusiv der Krankheit Endometriose widmete. Das Ursprungsmodell basiert auf der Endo-App, einer digitalen Gesundheitsanwendung (DiGA), die offiziell vom BfArM gelistet ist und auf Kassenkosten verschrieben werden kann. Im Jahr 2025 vollzog das Start-up jedoch den strategischen Sprung zur Multi-Disease-Plattform und launchte mit „Paula“ eine innovative App-Lösung für Betroffene des Polyzystischen Ovarialsyndroms (PCOS). Dieses enorme technologische Skalierungspotenzial für chronische Frauenkrankheiten überzeugte Geldgeber: Zu den Investoren der jüngsten Expansionsrunden zählen unter anderem Atreyu Investments, Cimexia GmbH, der Berlin Angel Fund und IBB Ventures.

Femfeel (Gründung: 2020)

Das Gründungstrio Janna Kraft, Marie Reger und Michaela Lehr widmet sich mit Femfeel der weiblichen Lebensmitte und überführt die Menopause in die digitale Versorgung. Ihr smartes B2B2C-Modell umgeht langwierige Rezept-Prozesse: Femfeel kombiniert App-basierte Begleitung mit evidenzbasierten Lebensstil-Interventionen, die offiziell als Präventionskurse (nach § 20 SGB V) zertifiziert sind und somit direkt von den Krankenkassen erstattet werden. Wie enorm wertvoll dieser präventive Markt geworden ist, bewies Femfeel durch einen hochbeachteten Exit: Das Start-up wurde von der Medice Health Family – einem Schwergewicht des deutschen Pharma-Mittelstands – übernommen und in dessen Digital-Health-Sparte integriert. Ein historisches Paradebeispiel dafür, wie stark die etablierte Industrie aktuell im FemTech-Sektor konsolidiert.

Frieda (Gründung: 2020)

Valentina Ullrich, Dr. med. Kai Schulze-Wundling und Thanh Schrader-Nguyen adressieren mit Frieda die Gendermedizin in der Menopause und gehen dabei tief in die klinische Diagnostik. Ursprünglich unter dem Namen Loba Health gestartet, agiert das Unternehmen heute als hybride digitale Klinik. Der USP: Statt den Östrogenabfall als Lifestyle-Thema abzutun, kombiniert Frieda datengestützte Telemedizin mit digitaler kognitiver Verhaltenstherapie (CBT) für eine evidenzbasierte Behandlung. Die Menopause wird hier als diagnostisches Fenster begriffen, um Gesundheitsdaten zur aktiven Prävention von altersbedingten Folgekrankheiten (wie Osteoporose) zu nutzen. Dieser konsequente Ansatz überzeugte auch den Schweizer Company Builder Maximon, der diese Brücke zur Langlebigkeit (Longevity) mit einem Seed-Investment von 2,5 Millionen Euro untermauerte.

Vyld (Gründung: 2021)

Ines Schiller und Melanie Schichan transformieren mit Vyld die Monatshygiene durch marine Biotechnologie. Das Start-up bietet sogenannte Kelpons aus Meeresalgen an. Dieser Rohstoff ist nicht nur radikal nachhaltig, sondern liefert einen massiven medizinischen USP: Algen sind von Natur aus hypoallergen, extrem saugfähig und kommen ohne schädliche Bleichmittel oder PFAS (Ewigkeitschemikalien) aus, was das empfindliche vaginale Mikrobiom aktiv schützt. Radikal ist bei Vyld auch die Struktur: Das Start-up agiert im Verantwortungseigentum (Steward-Ownership), wodurch Unternehmenszweck und Sicherheit stets vor kurzfristiger Gewinnmaximierung der Gesellschafter stehen. Dass dieser ethische DeepTech-Ansatz massiv skalieren kann, beweist die Finanzierung: Neben Impact-Investoren wie The Case for Her und millionenschweren Crowdinvesting-Instrumenten wird die Materialforschung von Vyld durch signifikante Fördermittel des Bundesministeriums für Bildung und Forschung (BMBF) validiert.

theblood (Gründung: 2022)

Das Gründerinnen-Duo Isabelle Guenou und Miriam Santer nutzt Menstruationsblut als diagnostische Goldmine. Ihr Geschäftsmodell basiert auf einer innovativen, nicht-invasiven Analyseplattform, die das lange tabuisierte Menstruationsblut nutzt, um ein breites Spektrum an Biomarkern – von Sexualhormonen bis hin zu essenziellen Nährstoffen wie Ferritin (Eisen) – zu tracken. Ein natürliches, zyklisches Abfallprodukt wird so zum hochwertigen Datensatz für die präventive Gesundheitsvorsorge, ganz ohne Nadelstich beim Arzt. Wie resilient und marktreif das Duo agiert, bewies es nach einem medienwirksam geplatzten TV-Investment („Die Höhle der Löwen“): theblood ließ sich nicht beirren und holte stattdessen hochkarätige strategische Partner an Bord. Dass dieser Ansatz massives Vertrauen genießt, zeigt die heutige Riege der Geldgeber: Neben Roosh Ventures und RoX Health investierte unter anderem Klosterfrau Ventures strategisch in die Berliner Pionierarbeit.

Internationaler Ausblick & Fazit

Der Blick über die deutschen Grenzen zeigt 2026 klar, in welche Richtung der Kompass navigiert. Aus den USA schwappt eine massive Welle der KI-basierten Wirkstoffentdeckung speziell für gynäkologische Erkrankungen nach Europa, während Asien die Hardware-Miniaturisierung für kontinuierliches Hormon-Tracking vorantreibt. Ein entscheidender globaler Makro-Trend ist jedoch die Souveränität der Intimdaten. In einer volatilen regulatorischen Ära in den USA (Post-Roe-v.-Wade) hat sich die europäische DSGVO vom Standortnachteil zum ultimativen Wettbewerbsvorteil entwickelt. Internationale Nutzerinnen suchen zunehmend Schutz bei europäischen Plattformen, die strikte Datensicherheit garantieren. Dies eröffnet deutschen Start-ups ungeahnte Exportchancen als absolute Vertrauensführer.

Für Gründer*innen und Investor*innen bedeutet dies: Die Zeit der reinen Wellness-Gadgets ist endgültig vorbei. Wer 2026 erfolgreich sein will, muss die Gender Data Gap schließen, klinische Evidenz liefern und den Datenschutz als ethisches Fundament begreifen. FemTech ist kein Nischen-Portfolio-Baustein mehr für die Diversity-Quote, sondern der am stärksten unterbewertete Treiber für die Zukunft der gesamten Gesundheitsökonomie. Wer heute in Gender-Medizin investiert, investiert in die Qualität der Medizin von morgen.

Blockchain-Start-up-Report 2026

Vorbei die Zeit der Krypto-Casinos: 2026 ist Blockchain das unsichtbare Betriebssystem der Wirtschaft. Die Top Start-ups, VCs und Trends im großen StartingUp-Report.

Es fühlt sich an wie ein anderes Zeitalter, wenn man auf die wilden frühen 2020er Jahre zurückblickt. Damals dominierten fliegende Hunde-Münzen wie Dogecoin, überteuerte Affen-Bilder des Bored Ape Yacht Club und toxische Goldgräberstimmung die Schlagzeilen. Heute, im Jahr 2026, hat die Blockchain-Technologie ihre Pubertät endgültig hinter sich gelassen. Der Wandel vom spekulativen Nischenthema zur unverzichtbaren Infrastruktur ist vollzogen. Wir sprechen nicht mehr über Krypto als Anlageklasse für Zocke*innen, sondern über distributed Ledger als das unsichtbare Betriebssystem der globalen Wirtschaft. Die Technologie ist leise geworden – und genau darin liegt ihr heutiger Wert für die Start-up-Welt.

Wenn Systemrelevanz auf MiCA trifft

Der europäische Markt für Web3- und Blockchain-Technologien hat einen nie dagewesenen Reifegrad erreicht. Der entscheidende Befreiungsschlag war die vollständige Implementierung der europäischen MiCA-Verordnung (Markets in Crypto-Assets), die den Kontinent vom regulatorischen Flickenteppich zum sichersten Hafen für institutionelles Kapital gemacht hat. Aktuelle Erhebungen des Bitkom und des KfW-Research zeigen, dass im Jahr 2026 bereits über 35 Prozent des deutschen Mittelstands die Technologie aktiv evaluieren oder Pilotprojekte mit Blockchain-Infrastruktur betreiben – primär im Supply-Chain-Management und der automatisierten Abrechnung.

Auf Investor*innenseite hat sich das Bild gewandelt: Statt Milliarden in unregulierte Token-Sales zu pumpen, fließen aktuell jährlich rund 1,8 Milliarden Euro klassisches Venture Capital in echte Equity-Runden der DACH-Region. Der absolute technologische Haupttreiber ist dabei die Konvergenz von künstlicher Intelligenz und Blockchain. Da KI-Agenten zunehmend autonom wirtschaftlich handeln, benötigen sie ein dezentrales, programmierbares und vor allem grenzenloses Zahlungssystem. Die Blockchain liefert exakt diese finanzielle Abwicklungsschicht für die Maschinenökonomie.

Die neuen Treiber jenseits der Krypto-Börsen

Wer heute noch Krypto-Exchanges oder reine NFT-Marktplätze baut, baut für die Vergangenheit. Der Markt des Jahres 2026 wird von drei hochspezifischen Sub-Sektoren dominiert, die das Internet grundlegend neu vernetzen.

- An vorderster Front steht DePIN (Decentralized Physical Infrastructure Networks). Hierbei wird reale Hardware – von Solarpanels bis hin zu 5G-Antennen – über Token-Incentives dezentral gesteuert und finanziert.

- Ebenso mächtig ist die Tokenisierung von Real World Assets (RWA), die den traditionellen Finanzmarkt revolutioniert, indem sie Anleihen, Immobilien und Kredite liquide auf die Chain bringt.

- Der dritte große Treiber sind Zero-Knowledge Proofs (ZKPs) – kryptografische Protokolle, die es Unternehmen erlauben, die Authentizität von Daten auf öffentlichen Blockchains zu beweisen, ohne sensible Geschäftsgeheimnisse offenzulegen. Globale Pioniere wie das auf RWA spezialisierte Netzwerk Centrifuge oder das US-Projekt Helium im Bereich DePIN haben den Weg geebnet, auf dem europäische Gründer*innen nun hochskalierbare B2B-Lösungen errichten.

Die Lektionen aus dem Billionen-Kollaps

Doch diese Reife hat einen extrem hohen Preis gekostet. Der spektakuläre Zusammenbruch der Krypto-Börse FTX und das Implodieren des algorithmischen Stablecoins Terra/Luna vor wenigen Jahren dienen heute als mahnendes Pflichtprogramm in jedem BWL-Seminar. Damals verdampften hunderte Milliarden Dollar, weil Gier über Substanz siegte.

Aus diesem Epochen-Crash lassen sich für heutige Gründer*innen vier fatale Fallstricke ableiten, die absolut tödlich enden:

- Der erste Irrtum liegt in der regulatorischen Arbitrage: Wer glaubt, Gesetze durch Offshore-Konstrukte und das Mantra "Code is Law" umgehen zu können, scheitert heute an gnadenlosen Aufsichtsbehörden.

- Zweitens zerstören künstlich aufgeblähte Token-Mechaniken jedes Projekt. Wenn die Unit Economics nur durch das permanente Drucken neuer Token künstlich positiv gehalten werden (Ponzinomics), bricht das Kartenhaus bei der geringsten Marktkorrektur zusammen.

- Die dritte Lektion betrifft den ewigen B2C-Fokus. Der verzweifelte Versuch, Endkund*innen komplexe Wallets und Seed-Phrases aufzuzwingen, ist gescheitert; der wahre Wert der Blockchain liegt derzeit fast ausschließlich in B2B-Lösungen, die im Hintergrund agieren.

- Zuletzt war das fehlende Treasury-Management ein Genickbruch für hunderte Teams. Wer die Reserven seines Unternehmens im eigenen, hochvolatilen Token hielt anstatt in Fiat oder echten Stablecoins, war bei Markteinbrüchen über Nacht insolvent.

Das deutsche Netzwerk: Wo die Knotenpunkte entstehen

Deutschland hat sich in dieser neuen Ära extrem smart positioniert und eine dezentrale Hub-Struktur aufgebaut, die weltweit ihresgleichen sucht. Berlin bleibt die unangefochtene Web3-Hauptstadt Europas. Die tiefe Verwurzelung der Ethereum Foundation und eine massive Dichte an internationalen Tech-Talenten machen die Spree-Metropole zum Epizentrum für Protokoll-Entwickler und Layer-1-Infrastruktur. Frankfurt am Main hat sich im Gegensatz dazu als der Hub für institutionelles DeFi (Decentralized Finance) und RWA-Tokenisierung etabliert. Hier verschmilzt die klassische Bankenwelt durch treibende Kräfte wie das Frankfurt School Blockchain Center mit der neuen Technologie. München spielt seine Trümpfe an der Schnittstelle von DeepTech, KI und Enterprise-Blockchain aus, stark befeuert durch Ausgründungen der TU München und die Nähe zu den Corporate Venture Labs von BMW und Siemens. Die heimliche Hauptstadt für den Milliardenmarkt DePIN ist jedoch die Achse Stuttgart/Karlsruhe. Durch das geballte Ingenieurswissen der Automobilzulieferer, gepaart mit Initiativen rund um Bosch, entsteht hier die direkte Verbindung zwischen dezentralen Netzwerken und der physischen Maschinen- und Mobilitätswelt.

Investor*innen-Radar: Smart Money für das Web3

Wer im Jahr 2026 eine Krypto-Infrastruktur finanzieren will, trifft auf eine hochgradig professionalisierte Investor*innenlandschaft. Auf der einen Seite agieren die spezialisierten VCs wie Greenfield Capital, Cherry Crypto oder 1kx. Sie bringen die notwendige technische Tiefe mit, um komplexe Zero-Knowledge-Architekturen oder Token-Design auf Herz und Nieren zu prüfen. Auf der anderen Seite stehen die Top-Tier Generalisten. Häuser wie Earlybird, Point Nine oder HV Capital haben intern längst dedizierte Web3-Partner aufgebaut und führen heute massive Series-A- und B-Runden an, sobald Start-ups bewiesen haben, dass ihre Technologie echte Kundenprobleme löst.

Ein massiver Wachstumsfaktor sind zudem die Corporate VCs der Industrie, allen voran CommerzVentures im FinTech-Sektor oder Porsche Ventures, die Brücken in die klassische Wirtschaft bauen. Der eigentliche Frühphasen-Motor wird jedoch von einer extrem agilen Angel-Szene angetrieben. Erfahrene Ex-Gründer wie Peter Großkopf oder gut vernetzte Angel-Syndikate recyceln ihr Kapital aus vergangenen Zyklen und finanzieren Pre-Seed-Runden oft innerhalb weniger Wochen.

Die Top Blockchain-Start-ups: Unsere Must-Watch Liste 2026

Für unsere Watchlist haben wir klare Kriterien angelegt. Die Auswahl umfasst ausschließlich deutsche Start-ups (mit Hauptsitz oder massiver Präsenz und Wurzeln hierzulande), die ab dem Jahr 2020 gegründet wurden. Wir haben Projekte aussortiert, die rein auf spekulativen Token-Sales basieren. Stattdessen lag unser Fokus auf Marktrelevanz nach dem Krypto-Winter, institutionellem Investor*innen-Vertrauen, technologischer Substanz und einem klaren Product-Market-Fit im B2B- oder tiefen Infrastrukturbereich.

Safe (Gründung 2022)

Das von Lukas Schor, Richard Meissner und Tobias Schubotz als Gnosis-Spin-off gegründete Safe betreibt eine B2B/B2C Smart Contract Account Infrastruktur. Der absolute USP ist die Account-Abstraktion und ihr Multi-Sig-Sicherheitsstandard, der mittlerweile das globale Rückgrat für die Verwahrung digitaler Assets durch Institutionen und DAOs bildet. In den letzten Runden sammelte das Team über 100 Millionen US-Dollar ein, angeführt von Schwergewichten wie 1kx und Tiger Global.

Peaq (Gründung 2020)

Till Wendler, Leonard Dorlöchter und Max Thake bauen mit Peaq eine hochspezialisierte B2B Layer-1 Blockchain. Ihre Technologie ist exakt auf den rasant wachsenden DePIN-Sektor und die "Economy of Things" zugeschnitten, wodurch Maschinen, Fahrzeuge und Roboter souveräne digitale Identitäten und Wallets erhalten. Die jüngsten Wachstumsrunden wurden unter anderem von Generative Ventures und Borderless Capital mit gut 15 Millionen Dollar als Lead-Investoren getragen.

Chainflip (Gründung 2020)

Simon Harman hat mit Chainflip eine B2B2C Cross-Chain Decentralized Exchange (DEX) in Berlin etabliert. Der technologische Vorsprung liegt im nativen Tausch von Krypto-Assets über verschiedene Blockchains hinweg (wie Bitcoin zu Ethereum), ohne dass Nutzer*innen anfällige "Wrapped Tokens" oder unsichere Bridges nutzen müssen. Pantera Capital und Framework Ventures glaubten früh an die Vision und führten Investments in Höhe von über 24 Millionen Dollar an.

Arcium (ehemals Elusiv, Gründung 2022)

Yannik Schrade, Julian Deschler und ihre Co-Founder adressieren mit Arcium eines der größten Probleme der Enterprise-Adoption: Privatsphäre auf öffentlichen Blockchains. Ihr Geschäftsmodell ist ein B2B Confidential Computing Network, dessen USP in der Nutzung von Zero-Knowledge Proofs liegt, wodurch Daten verifiziert werden können, ohne sie zu entschlüsseln. Der auf Krypto spezialisierte Fonds Greenfield Capital sicherte sich hier gemeinsam mit Solana Ventures in frühen Runden mit einem Volumen von über 5 Millionen US-Dollar den Lead.

Gelato Network (Gründung 2020)

Hilmar Orth und Luis Schliesske agieren mit Gelato Network tief im Maschinenraum des Web3. Ihr B2B-Geschäftsmodell ist ein Automatisierungs- und Relayer-Netzwerk. Der USP besteht darin, dass Entwickler über Gelato Smart Contracts automatisieren und sogenannte Rollup-as-a-Service-Lösungen nutzen können – es ist quasi das AWS-Backend für dApps. Die Vision überzeugte Top-Fonds wie Dragonfly und IOSG Ventures, die Kapital in zweistelliger Millionenhöhe bereitstellten.

Unstoppable Finance (Gründung 2021)

Das Berliner Start-up Unstoppable Finance startete unter den Gründern Peter Großkopf, Maximilian von Wallenberg und Omid Aladini ursprünglich mit einer B2C-DeFi-Wallet. Nach einem radikalen strategischen Pivot und dem operativen Ausstieg von Großkopf im Jahr 2024 wandelten Wallenberg und Aladini das Modell erfolgreich zu einer B2B-Infrastruktur für Stablecoins. Der starke USP ist der Aufbau einer vollumfänglich regulierten Brücke („Swift 2.0“), die es institutionellen Kunden vereinfacht, Stablecoins nahtlos in ihre traditionellen Produkte einzubinden. Lightspeed Venture Partners und Speedinvest führen hier das Cap Table mit einem 12,5-Millionen-Dollar-Investment an.

Senken (Gründung 2022)

Das Gründerteam um Adrian Wons, René Schäfer und Djamel Mekibes verknüpft Blockchain mit echtem Klimaschutz. Sie bauen einen B2B-Marktplatz für den Handel mit tokenisierten CO2-Zertifikaten (Carbon Credits). Der USP dieses Regenerative Finance (ReFi) Modells ist die absolute Transparenz und Nachverfolgbarkeit von Klimakompensationen, die das Double-Spending-Problem klassischer Zertifikate eliminiert. Obvious Ventures und namhafte Krypto-Fonds investierten frühzeitig in Senken rund 7,5 Millionen US-Dollar.

Internationaler Ausblick & Fazit

Der Blick über die europäischen Grenzen zeigt, dass die Innovationszyklen rasant bleiben. Aus den USA schwappt aktuell der Makro-Trend der „Chain Abstraction“ zu uns herüber: Blockchain-Technologie wird im Backend so unsichtbar, dass Nutzer*innen gar nicht mehr wissen, auf welchem Netzwerk sie sich bewegen – ähnlich wie heute niemand mehr TCP/IP versteht, um das Internet zu nutzen.

Gleichzeitig forcieren asiatische Märkte, allen voran Singapur und Hongkong, mit massiven staatlichen Förderungen die Verschmelzung von KI-Agenten und Krypto-Payments. Zudem zwingt die globale Entwicklung von digitalen Zentralbankwährungen (CBDCs) die Finanzsysteme endgültig zur Modernisierung.

Für Gründer*innen und Investor*innen lautet das aktuelle Fazit daher so simpel wie hart: Wer heute in der Blockchain-Branche überleben will, muss bauen wie ein traditionelles Softwareunternehmen – besessen davon, echte, drängende Probleme der Wirtschaft zu lösen, nur eben mit einer radikal überlegenen, dezentralen Architektur.

Ende einer Vision: Warum die creätr-Gründerinnen den Stecker ziehen

Es sollte der nachhaltige Gegenentwurf zu Fast Fashion in der Umstandsmode werden. Doch das Frankfurter Label creätr der Gründerinnen Verena Seipp und Viktoria Ibbett zieht nach fünf Jahren den Stecker. Wir haben uns mit den beiden Gründerinnen über das Aus unterhalten: Ein lehrreiches Fallbeispiel über die Tücken hoher Produktionsstandards, falsche Pricing-Strategien und die harte Realität in einem preissensiblen Nischenmarkt.

Der Markt für Umstandsmode ist kein leichter: Die Tragedauer der Kleidung ist naturgemäß begrenzt, weshalb viele werdende Mütter aus Kostengründen zu günstiger Fast Fashion greifen. Genau hier wollten die Frankfurter Schwestern Verena Seipp und Viktoria Ibbett vor fünf Jahren ansetzen. Mit der Gründung ihres Labels creätr traten sie an, um eine hochwertige und funktionale Alternative zu schaffen. Ihre Vision: Kleidung für Schwangerschaft und Stillzeit, die Mütter dank durchdachter Funktionen und modernem Design auch lange nach der Mutterschaft noch begleitet.

Doch die Schere zwischen der Vision einer „erreichbaren Marke“ und der tatsächlichen Marktrealität ging schnell auf. „Das haben wir tatsächlich schon relativ früh gemerkt“, räumt Verena ein. Spätestens in der Produktion sei das Dilemma offensichtlich geworden: „Wenn wir all unsere Ansprüche an faire Herstellung, Nachhaltigkeit und hochwertige, langlebige Materialien erfüllen wollen, landen wir automatisch bei einem Preisniveau, das nicht mehr für alle erreichbar ist.“

Die rote Linie bei der Produktion

Die Fertigung sollte von Beginn an kompromisslos verantwortungsvoll sein und fand daher in Europa – konkret in Deutschland, Portugal und Italien – statt. Dieser ethische und qualitative Anspruch erwies sich rückblickend jedoch als enorme wirtschaftliche Herausforderung.

Hätte man nicht einfach in günstigere, nicht-europäische Länder ausweichen können, um die Preise zu senken? „Am Anfang war das für uns ganz klar eine rote Linie“, betont Viktoria. Man habe ihnen schlichtweg vermittelt, dass faire Arbeitsbedingungen und Qualität nur in Europa wirklich sicherzustellen seien. Heute sieht sie das differenzierter: „Mit zunehmender Erfahrung und einem größeren Netzwerk haben wir gelernt, dass es durchaus auch außerhalb Europas verantwortungsvolle Produktionsmöglichkeiten gibt. Diese Perspektive hatten wir zu Beginn so noch nicht.“

Die Pricing-Falle: Wenn externe Beratung am Markt vorbeigeht

Die hohen europäischen Produktionskosten erzwangen Margen, die das Start-up schnell in eine Sackgasse führten. In der kritischen frühen Aufbauphase verließ sich das Gründerduo auf externe Beratung – und positionierte creätr auf deren Anraten stark im Luxussegment. Ein Blick in das Archiv des Webshops verdeutlicht die harte Dimension: Ein Umstands-Sweatshirt schlug regulär mit 289 Euro zu Buche, ein Hoodie kostete 239 Euro, für ein einfaches Still-T-Shirt wurden 169 Euro aufgerufen.

Warum vertrauten die Schwestern der Beratung mehr als ihrem eigenen Gespür für die Zielgruppe? „Diese Frage trifft den Kern unseres größten Learnings – und wir haben sie uns selbst oft gestellt“, reflektiert Viktoria offen. Als unerfahrene Gründerinnen seien sie davon ausgegangen, dass ein Berater mit jahrzehntelanger Branchenerfahrung den Markt schlicht besser einschätzen könne. Ein fataler Irrtum, wie Verena ergänzt: „Rückblickend war genau das einer unserer größten Fehler.“ Ihr dringender Rat an andere lautet daher: „Vertraue deinem eigenen Bauchgefühl – vor allem, wenn du das Problem und deine Zielgruppe wirklich verstehst.“

Für ein Label, das angetreten war, um eine greifbare Alternative für möglichst viele Mütter zu sein, war dies ein gefährlicher strategischer Schwenk. „In diesem Segment authentisch zu verkaufen, fühlte sich für uns zunehmend nicht richtig an“, resümieren die Gründerinnen heute kritisch. Die tiefe Diskrepanz zwischen dem eigenen moralischen Kompass, dem massiven Preis und der Lebensrealität der Mütter ließ sich auf Dauer nicht überbrücken.

Starke Konkurrenz und psychologische Schwellen

Hinzu kam ein hartes Wettbewerbsumfeld, das verdeutlichte, warum das Luxus-Modell in dieser Nische so schwer durchzusetzen ist. Zwar gibt es einen wachsenden Markt für nachhaltige Maternity Wear, doch selbst etablierte Premium-Wettbewerber wie Boob Design, Mara Mea oder Seraphine rufen für vergleichbare Stücke deutlich niedrigere Preise auf – oft zwischen 60 und 130 Euro.

Auf Babymessen und Pop-up-Events bekamen die Schwestern diese Marktrealität unmittelbar zu spüren. Zwar lobten die Kundinnen die Spürbarkeit der hohen Qualität, doch die Kauflaune blieb aus. „Viele haben offen gesagt, dass sie während der Schwangerschaft ohnehin schon viel fürs Baby ausgeben und deshalb bei sich selbst sparen“, fasst Viktoria die Ernüchterung zusammen. Verena bestätigt das: „Die psychologische Grenze kam immer wieder auf. Viele haben klar gesagt, dass sie – abgesehen vielleicht von einer Winterjacke – nicht bereit sind, über 200 Euro für ein einzelnes Kleidungsstück auszugeben.“ Gegen diese psychologische Hürde bei einer temporären Lebensphase half letztlich auch der Ansatz auf langlebiges Design nicht.

Fazit: Authentizität schlägt Berater-Theorie

Das Ende von creätr ist eine klassische Lektion für die Start-up-Szene. Die mathematisch korrekte Preiskalkulation für eine faire, europäische Produktion muss zwingend mit der Zahlungsbereitschaft des Marktes einhergehen. Wenn externe Strategen ein Unternehmen in ein Segment drängen, das nicht zur Grundidee passt, geht nicht nur die Authentizität verloren, sondern auch das Geschäftsmodell.

Mittlerweile haben die Schwestern die creätr GmbH in Liquidation geschickt und das Ende der Marke angekündigt. Aktuell läuft ein radikaler Schlussverkauf, bei dem sämtliche Teile der Kollektion für nur noch 29 Euro angeboten werden, um die Läger zu leeren und die Kleidung zumindest noch ihrem eigentlichen Zweck zuzuführen. Ein harter Schlussstrich unter ein ambitioniertes Projekt.

Was würden sie anderen Gründerinnen und Gründern in der Sustainable Fashion mit auf den Weg geben? „Sei dir wirklich klar darüber, wofür dein Produkt steht und was du erreichen willst“, rät Verena Seipp eindringlich. „Dieses Ziel sollte dein Nordstern sein – und die Basis für jede Entscheidung.“

Zudem warnt Viktoria Ibbett vor zu großen Ambitionen am Anfang: „Starte klein. Wirklich klein. Konzentriere dich am Anfang auf ein Produkt, teste es, optimiere es und baue darauf auf.“ Dass ihnen damals geraten wurde, direkt mit einer gesamten Kollektion zu starten, sei ein Fehler gewesen. Es war nicht nur teuer, sondern verwässerte auch die Botschaft: „Mit einem klaren Hero-Produkt ist vieles einfacher: Marketing, Kommunikation und vor allem das Verständnis bei den Kundinnen, wofür deine Marke eigentlich steht.“

Angriff auf die Giganten: Das Milliarden-Business mit dem „schnellen Teil“

Wie die SPAREPARTSNOW-Gründer Dr. Christian Hoffart und Sebastian Kleinschmager von München aus den Weltmarkt für Ersatzteile umkrempeln und US-Distributoren das Fürchten lehren wollen.

Ein defektes Bauteil, ein rauchendes Fließband und ein wirtschaftlicher Schaden von 100.000 Euro pro Tag: Der Albtraum eines jeden Werksleiters ist oft bittere Realität. Während der private Konsum längst im „Next-Day-Zeitalter“ angekommen ist, glich die Beschaffung von Industrieteilen bisher einer archäologischen Expedition durch verstaubte Fax-Listen und intransparente Händlerstrukturen. Das Münchner Start-up SPAREPARTSNOW beendet diese Ära nun endgültig und beweist, dass „DeepTech made in Germany“ das Zeug zur globalen Disruption hat.

Die Geburtsstunde einer Milliarden-Idee

Trotz Industrie 4.0 scheiterte der Maschinenbau bisher oft an einer simplen Hürde: der Ersatzteil-Logistik. Zwischen dem Originalhersteller (OEM) und dem Endkunden in den USA oder Asien lagen meist drei bis fünf Zwischenstationen. Jede dieser Stationen kostete wertvolle Zeit und schlug massive Margen auf das Produkt auf. Die Folge war ein absurdes Ungleichgewicht: Ein in Deutschland produziertes Bauteil kam im Ausland oft mit Wochen Verspätung und zum doppelten Preis an.

Hier setzten Dr. Christian Hoffart und Sebastian Kleinschmager im Jahr 2022 an. Ihre Vision war so simpel wie radikal: Die Disintermediation – das radikale Ausschalten des Zwischenhandels. SPAREPARTSNOW verbindet die Industrie-Giganten direkt mit den Fabrikhallen weltweit. Was 2022 mit 20.000 Artikeln begann, ist bis heute – im Februar 2026 – auf ein digitales Ökosystem von über 5 Millionen Ersatzteilen angewachsen.

Der technologische Kraftakt hinter dem Wachstum

Für StartingUp-Leser*innen ist besonders die Skalierung interessant. Von 20.000 auf 5 Millionen Teile zu wachsen, ist kein reiner Vertriebserfolg, sondern eine technologische Meisterleistung. Während Sebastian Kleinschmager im Hintergrund die KI-gestützten Identifikationsalgorithmen verfeinerte, die heute selbst unscharfe Fotos von Bauteilen in Millisekunden zuordnen, musste das Team die Datenhoheit der oft skeptischen OEMs gewinnen.

Strategischer Meilenstein: Frontalangriff auf Nordamerika

Im Februar 2026 steht SPAREPARTSNOW vor seinem bisher kühnsten Schritt: dem Markteintritt in Nordamerika. Die Strategie ist ein Frontalangriff auf etablierte US-Distributoren. Durch die direkte OEM-Anbindung bietet SPAREPARTSNOW europäische Top-Marken in den USA zu Preisen an, die 20 bis 50 Prozent unter dem bisherigen US-Marktniveau liegen. Der „Transatlantik-Express“ garantiert zudem, dass ein Bauteil aus Süddeutschland oft schon am nächsten Werktag in einer US-Fabrik eintrifft. Geschwindigkeit ist hier die einzige Währung, die gegen den drohenden Stillstand hilft.

München oder Silicon Valley?

Trotz der globalen Ambitionen bleibt SPAREPARTSNOW fest in der bayerischen Landeshauptstadt verwurzelt. In einer Welt, in der Start-ups oft schielten, sobald das erste Wagniskapital aus den USA winkte, blieb das Team dem Standort München treu. Hier sitzt die Kompetenz des Maschinenbaus, hier ist die Nähe zu den Herstellern – ein strategischer Vorteil, den kein Algorithmus der Welt ersetzen kann.

Die Zukunft der globalen Instandhaltung

Mit dem Rollout in den USA und dem geplanten Sprung nach Südostasien im dritten Quartal 2026 schließt sich der Kreis zu einem globalen Netzwerk. SPAREPARTSNOW beweist, dass Mut zur Lücke und technologische Tiefe ausreichen, um jahrzehntealte Monopole aufzubrechen. Durch die Kombination aus radikaler Preistransparenz, KI-gestützter Teilesuche und einer Logistik, die Kontinente in Stunden überbrückt, schafft das Unternehmen einen fundamentalen Fortschritt für die weltweite Industrie. In einer Zeit, in der Resilienz und Schnelligkeit über die Wettbewerbsfähigkeit ganzer Wirtschaftsstandorte entscheiden, wird SPAREPARTSNOW vom bloßen Marktplatz zum unverzichtbaren Rückgrat einer digitalisierten, globalen Produktion, die nicht nur schneller und günstiger, sondern durch die Integration von Refurbished-Teilen und reduzierten Lagerwegen auch nachhaltiger agiert.

NBH-Systems: Zwischen Schaltschrank und Skalierbarkeit

Wie Dorian Tobollik und Timo Hartig mit ihrem Hardware-Start-up NBH-Systems eine Industrie-Nische knacken wollen.

Laptops, die prekär auf Maschinengehäusen balancieren, oder kniende Instandhalter*innen, die notgedrungen mit einer Hand tippen – der Arbeitsplatz im technischen Service ist selten ergonomisch. Aus genau diesem alltäglichen „Pain Point“ heraus ist das Start-up NBH-Systems entstanden. Wie Dorian Tobollik und Timo Hartig mit ihrem Hardware-Unternehmen eine Industrie-Nische knacken wollen, haben wir analytisch unter die Lupe genommen.

Vom Pain Point zum Produkt

Die Entstehungsgeschichte des hessischen Start-ups ist ein klassisches Lehrstück für anwendergetriebene Innovation. Dorian Tobollik, selbst langjähriger Systemtechniker, erlebte das Fehlen eines stabilen Arbeitsplatzes an Maschinen und Anlagen immer wieder als echten Effizienz- und Sicherheitskiller. Anstatt den Status quo hinzunehmen, ging er ans Reißbrett und entwickelte eigene Prototypen.

Doch der Weg zur Serienfertigung „Made in Germany“ barg Tücken. „Der Weg vom ersten Prototyp bis zur Serienfertigung war deutlich aufwendiger, als ich am Anfang gedacht habe“, räumt Tobollik rückblickend ein. Der große Vorteil lag jedoch in seiner eigenen Berufspraxis: „Die Idee kam direkt aus meinem Arbeitsalltag als Servicetechniker. Ich habe das Produkt selbst täglich im Einsatz gehabt, konnte es direkt testen und immer wieder anpassen.“

Die Teufel steckten bei der Umsetzung im Detail – von Gewicht und Größe über die Kompatibilität der Notebook-Formate bis hin zur exakten Stärke der Magnete. „Das sind Dinge, die man nicht am Schreibtisch löst, sondern nur im Alltag“, betont das technische Gehirn des Duos. Aus purer Überzeugung ließ er den vielversprechenden Ansatz direkt patentieren.

Um aus der funktionalen Erfindung ein marktfähiges Unternehmen zu formen, stieß Timo Hartig dazu. Er verantwortet als Geschäftsführer den Vertrieb und das Marketing, während Tobollik sich auf die Produktentwicklung fokussiert. Ende 2025 mündete dies in der Gründung der NBH-Systems UG im hessischen Seligenstadt.