Aktuelle Events

8 Tools, die jeder Gründer kennen(lernen) sollte.

Wer ein Start-up aufbaut, sollte von Tag eins an ein Fundament an digitalen Tools aufbauen, mit dem kontinuierliche Verbesserungen am Produkt und skalierbares Wachstum möglich sind.

Eine solche “Tool-Kultur” lässt sich nur top-down erzeugen, daher sollten Gründer die effektivsten Tools selbst nutzen und beherrschen, um dieses Wissen dann an ihr Team weitergeben zu können.

Das Ziel ist, dass alle Teammitglieder möglichst autonom arbeiten können und in der Lage sind,

- über die richtigen Plattformen mit den richtigen Menschen zu kommunizieren

- skalierbare digitale Prozesse zu schaffen, die starkem Wachstum standhalten

- sich wiederholende, zeitfressende Aufgaben eigenständig zu automatisieren.

Selbstverständlich unterscheidet sich der konkrete Bedarf an Tools von Branche zu Branche und von Unternehmen zu Unternehmen. Daher erhebt diese Liste keinen Anspruch auf Vollständigkeit, aber sie zeigt, welche grundlegenden Funktionalitäten und Prozesse beinahe jedes Startup mit geeigneten Tools beherrschen sollte.

Slack - Allgemeine Kommunikation

Ein naheliegender Ausgangspunkt. Slack ist ein Kommunikationswerkzeug, das entwickelt wurde, um einen digitalen Workspace durch ein System von Channels zu schaffen, das sich auf bestimmte Themen konzentriert, z.B. #Engineering, #Sales, #Gifs-memes.

Manchmal heißt es, Slack sei wie eine Business-Version von Whatsapp. Es gibt tatsächlich einige Parallelen: Man kann Audio- und Videoanrufe 1:1 oder in Gruppen führen, den Bildschirm gemeinsam nutzen, einen Hinweis erhalten, wenn neue Nachrichten da sind. Aber eigentlich geht der Vergleich an der Sache vorbei. Slack ist eines der revolutionärsten Tools in der heutigen Geschäftswelt. Die meisten Menschen wissen einfach nicht, wie man es richtig einsetzt.

Es ist erstaunlich, wie häufig die folgenden Basics beim Einsatz von Slack NICHT beherzigt werden:

- Sales-, Marketing-, Engineering- und Produkt-Tools in die jeweiligen Kanäle integrieren.

- Unterschiedliche Kanäle, Threads und semantische Emoticons korrekt verwenden.

- Sicherstellen, dass alle Offline-Gespräche oder -Meetings effizient dokumentiert werden.

- Alle neuen Teammitgliedern klare Kommunikationsrichtlinien an die Hand geben.

Jeder, der es schon einmal in einer Führungsposition war, wird wissen, wie toll es ist, wenn jemand so kommuniziert, wie man es sich wünscht. Sobald alle Teammitglieder in der Lage sind, mit Slack effektiv zu kommunizieren, stellt das Arbeiten von zu Hause oder von unterwegs übrigens keine große Herausforderung mehr dar.

Ähnliche Kommunikations-Tools: Microsoft Teams

Hubspot - CRM-System mit Marketing-Suite

Ein Customer Relationship Management (CRM)-System "ermöglicht es Unternehmen, Geschäftsbeziehungen und die damit verbundenen Daten und Informationen zu verwalten" (Salesforce-Blog). Wenn ein Unternehmen mit der Vermarktung seines Produkts oder seiner Dienstleistung beginnt, versucht es, Informationen über potenzielle Kunden (qualifizierte Leads) zu generieren und zu speichern. Diese Informationen können sich auf den Hintergrund (Name, E-Mail, Stellenbezeichnung) oder das Verhalten einer Person oder eines Unternehmens beziehen (haben sie eine bestimmte E-Mail geöffnet, auf einen Link geklickt, die Webseite aufgerufen).

Eine Datenbank über Personen oder Unternehmen ist notwendig, aber für sich genommen noch nicht hilfreich, wenn es um Automatisierung geht. Was Unternehmen immer wieder versuchen, ist auf der Grundlage bestimmter Hintergründe oder Verhaltensweisen die Automatisierung von Aufgaben zu erreichen, die sonst manuell erledigt werden müssten.

Hier kommt Hubspot und die integrierte Marketing-Suite ins Spiel. Wenn man lernt, damit umzugehen, kann man anfangen, über die Architektur der Datenbank nachzudenken, Persona (Kundensegmente) erstellen und andere Marketinginstrumente (Typeform, Mailchimp, Eventbrite usw.) in die Datenbank zu integrieren.

Die wahre Magie kommt jedoch zum Vorschein, wenn man über Hubspot-Workflows erstellt. Das bedeutet, dass ein bestimmtes Verhalten eine Aktion auslöst (ähnlich wie weiter unten bei Zapier). Zum Beispiel ist ein Kunde, der eine E-Mail öffnet und auf einen bestimmten Inhalt klickt, es wert, eine Folge-E-Mail zu senden, im Gegensatz zu jemandem, der sie gar nicht öffnet.

Das Entscheidende ist, dass man dann beginnt, Marketing-Psychologie als datenbasiert zu begreifen. Mit Hilfe der Daten von Hubspot aus A/B-Tests, der Analyse auf der Webseite, die geöffnet wird, und der Lead-Erfassung per E-Mail wird man in die Lage versetzt, Marketing sowohl aus qualitativer als auch aus quantitativer Sicht zu verstehen. Hubspot hat sogar eine nette kleine "Akademie", in der man etwas über das Tool und einige der Grundlagen dahinter lernen kann: Hubspot-Akademie.

Ähnliche Tools: Salesforce, Marketo, Pipedrive

Figma - Product Design

Jeder in einem digitalen Start-up sollte grundlegende Design-Fähigkeiten haben. Denn unabhängig davon, in welchem Bereich man tätig ist, wird es einen Moment geben, in dem man visuell zeigen muss, was man meint. Man muss kein UI-, UX- oder Grafikdesigner sein. Stattdessen muss man die visuelle Gestaltung gerade genug beherrschen, um bei dem, was man zu erreichen versucht, autonom zu sein.

Figma ist wohl das beste Werkzeug für Design-Neulinge, um ein Design schnell nachbilden zu können. Dies gilt insbesondere für alle, die für ein Unternehmen mit einem digitalen Produkt oder einer digitalen Website arbeiten (was heutzutage quasi jedes Start-up ist!). Wenn man lernt, damit umzugehen, kann man seinem Team unkompliziert die eigene Vision zeigen, einfache Mockups und Prototypen erstellen und die Sprache der Designer sprechen.

Figma ist aus drei Gründen ein erstaunliches Tool. Man kann damit:

- Zusammenarbeiten - Per E-Mail erhalten Kollegen Zugriff auf ein Design, das dann alle gemeinsam und gleichzeitig im Browser bearbeiten können.

- Skalieren - Wenn man ein Design für eine Website oder eine Anwendung erstellt, kann man festgelegte Komponenten verwenden, um die Konsistenz des gesamten Designs zu gewährleisten.

- Prototypen erstellen - Man kann einen Prototyp einer Website oder App erstellen oder daran arbeiten. Man kann dann eine "Live"-Demo davon präsentieren, indem man verschiedene Seiten (sogenannte "Frames") miteinander verknüpft und sie durch Anklicken miteinander verbinden.

Zur Einführung gibt es einige Video-Tutorials von Figma.

Ähnliche Tools: Sketch, Invision

Zapier - Automatisierung

Echte Autonomie erreicht man, wenn man im Unternehmen digitale Aufgaben erledigen kann, ohne sie tatsächlich selbst auszuführen. Dies kann man durch Automatisierung erreichen. Durch die Verbindung von APIs (Application Programming Interfaces) aus verschiedenen digitalen Tools kann man diese über eine festgelegte Logik miteinander kommunizieren lassen.

In vielen Anwendungen sind diese Integrationen bereits eingebaut. Wenn man beispielsweise Typeform verwendet, kann man sich automatisch mit Slack, Google Sheets und Hubspot "verbinden". Da diese APIs jedoch alle spezifische Möglichkeiten zur Strukturierung von Daten haben, ist es für ein Unternehmen mit einer eigenen API so gut wie unmöglich, jede mögliche Integration mit jeder anderen möglichen Anwendung aufzubauen. Wenn ein Nutzer beispielsweise in einem Typeform-Formular Daten einträgt, möchten man vielleicht, dass er automatisch zum CRM hinzugefügt wird, dass er einer Mailingliste hinzugefügt wird, dass er eine E-Mail erhält und dass die relevanten Leute im Team eine Benachrichtigung über Slack erhalten. Doch die Integrationen, die Typeform bietet, gehören möglicherweise nicht zu der spezifischen Anwendung, die man verwendet oder sind nicht in der gewünschten Weise angepasst.

An dieser Stelle kommt Zapier ins Spiel. Man kann es sich wie einen Adapter für mehr als 2000 Anwendungen vorstellen. Man schließt eine Anwendung an eine Seite des Adapters an, und er nimmt die Daten in einer bestimmten Struktur auf. Zapier strukturiert die Daten dann so um, dass man sie in die andere Anwendung importieren und beide effektiv miteinander verbinden kann. Sobald man seine Arbeit auf diese Weise angeht, fängt man an, wie ein Entwickler zu denken. Alles, was sich wiederholt und zeitintensiv ist, kann automatisiert werden. Zapier bietet die Möglichkeit, wie ein Entwickler zu arbeiten, ohne ein Entwickler zu sein!

Häufig fängt man so an, dass man Zapier nutzt, um Integrationen zu testen. Wenn man dann wächst, ersetzt man alle Integrationen in Zapier durch Code, um Kosten zu sparen, da Zapier in großem Maßstab sehr teuer sein kann.

Zapier hat jetzt seine eigene "Universität" (das ist definitiv eine Übertreibung) mit 2-minütigen Videos, die einen Überblick darüber geben, wann und wie man das Produkt verwenden kann.

Ähnliche Tools: IFTTT, Automate

Notion - Wissensmanagement

Notion ist ein Wissensmanagement-Tool, das von Start-ups verwendet wird, um ihre Ressourcen und Prozesse über verschiedene Abteilungen oder Bereiche hinweg zu strukturieren. Zu wissen, wie man Wissen strukturiert und kommuniziert, ist als Thema eher unsexy. Wenn man es aber richtig macht, führt es zu Teammitgliedern, die etwas selbstständig ausführen, im Gegensatz zu solchen, die um Hilfe bitten müssen und so weniger effizient sind.

Jeder in meinem Team bei Le Wagon weiß, dass ich von Notion besessen bin. Ich nutze es sogar in meinem Privatleben! Die Stärke des Tools besteht darin, dass es bestehende Werkzeuge in einer Plattform kombiniert und es den Nutzern ermöglicht, Wissen auszutauschen und Daten in verschiedenen "Komponenten" zu speichern. Diese Komponenten ermöglichen es, "Seiten" zu erstellen und Informationen mit einer beeindruckenden Nutzererfahrung zu präsentieren. Man kann z.B. Dateien speichern (Google Drive), eine Kanban-Tafel erstellen (Trello), in einer Tabellenkalkulation arbeiten (Excel), Projekte verwalten (Asana), Vorlagen für Meetings pflegen, Kalender erstellen - und die Liste ist sogar noch länger.

Bei Le Wagon waren die größten Vorteile durch Notion folgende:

- Lokale Prozesse: Da wir in vielen Städten auf der ganzen Welt aktiv sind, haben wir sowohl lokale als auch globale Prozesse. Jede Stadt hat ihren eigenen Bereich, in dem lokale Prozesse erfasst werden können und Wissen ausgetauscht werden kann.

- Meetings effektiv strukturieren: Jedes Mal, wenn wir ein Meeting durchführen (Abteilungsmeeting, monatliche All-Hands, vierteljährliche Reviews), verwendet die Person, die das Meeting leitet, einen "Vorlagen-Button" und füllt die Details des Meetings aus, bevor es stattfindet. Dies ermöglicht kurze Meetings, die vorher überprüft werden können.

- Onboarding: Jeder, der bei Le Wagon einsteigt, erhält eine Onboarding-Seite von Notion mit einer übersichtlichen Leseliste zu den unterschiedlichen Prozessen und Informationen zum Team. Man hat dann auch eine To-Do-Liste für die ersten Wochen, die man abhaken muss.

- Zielüberwachung: Wenn wir unsere OKRs und Team-Roadmaps zusammenstellen, stellen wir sicher, dass diese für alle im Team öffentlich gezeigt werden.

Wie bei Slack ist auch bei Notion das Wichtigste, dass man sich Zeit dafür nimmt, wie man kommuniziert, und dass man lernt, das Tool richtig zu benutzen (Backlinks, Vorlagen-Schaltflächen, Tabellenansichten, es gibt eine Menge zu lernen). Hilfreich ist dieser Youtube-Guide zu Notion.

Typeform - Formulare und Lead-Erfassung

Was ist der einfachste Weg, Feedback zu einem MVP zu erhalten? Was ist der einfachste Weg, Leads zu erfassen? Was ist der einfachste Weg, Bewerbungen zu erfassen? Man baut ein Formular. Das ist eine einfache, aber sehr wichtige Aufgabe. Es ist allerdings erstaunlich, wie viele Gründer ein Formular zusammenstellen, das nicht die richtigen Daten auf die richtige Art und Weise erfasst. Ob es sich nun um Marktforschung, HR-Umfragen oder das Onboarding neuer Partner handelt - das Sammeln von Informationen muss effizient und mit einer guten Benutzererfahrung erfolgen.

Genau hier kam Typeform ins Spiel. Die Gründer von Typeform sahen sich damals die Wettbewerber an und stellten fest, dass der einzige Bereich, der massiv verbessert werden könnte, die Art und Weise war, wie ein Formular aussieht und wie man sich darin fortbewegt. Sie schufen daher einen einfachen, aber leistungsfähigen Formular-Generator, der verschiedenste Arten von Fragen beinhaltet. Für den Empfänger fühlt sich das Ausfüllen des Formulars dann erstens elegant und einfach an und steht zweitens auch im Einklang mit dem optischen Erscheinungsbild der Marke.

Eine wichtige Sache, die es zu lernen gilt, ist das Hinzufügen eines "Logiksprungs". Dies ermöglicht es den Nutzern, abhängig von den Antworten der Empfänger unterschiedliche Fragen zu stellen. Wenn das Formular dann fertig ist, kann man eine Vielzahl von Integrationen verwenden, um das Endergebnis mit anderen Anwendungen wie Google Drive, Hubspot, Slack und vielen anderen zu verbinden.

Wenn man das mal testen möchte, kann man bei Typeform direkt loslegen, denn das Tool ist sehr einfach zu bedienen.

Vergleichbare Tools: SurveyMonkey, Google Forms

Mailchimp - E-Mail-Marketing

Wirklich jeder Gründer sollte wissen, wie man eine Marketing-E-Mail verschickt. Sobald man all die wertvollen E-Mail-Adressen der ersten Leads gesammelt hat, muss man sie pflegen: auf sinnvolle Weise über das Produkt informieren, Upsells anbieten, interessante Inhalte vermitteln.

Zwar ist dies eine der ältesten Formen der digitalen Kommunikation, gleichzeitig aber eine der kosteneffizientesten. Während Hubspot fantastisch ist, um das Nutzerverhalten abzubilden, konzentriert sich Mailchimp auf die massenhafte Zustellung von Marketing-E-Mails an Kundensegmente. Auch Formulare für die Lead-Erfassung stehen zur Verfügung. Viele Startups nutzen Mailchimp in der Anfangsphase, um ihren Nutzerkreis durch Content-Marketing und Produkt-News zu vergrößern. Durch den Erhalt informativer und/oder lehrreicher E-Mails sollen die Benutzer wieder zum Produkt zurückgeführt werden, um sich mit ihm zu beschäftigen.

Im Laufe der Jahre hat Mailchimp auch das Erstellen von Webseiten hinzugefügt und Online-Zahlungen integriert, so dass E-Commerce-Plattformen mit dem Tool in der Frühphase effektiv wachsen können.

Ähnliches Tool: ConstantContact

Front - Kundenkommunikation

Wenn ein MVP an Popularität gewinnt, kann ein überquellender Posteingang zu einem Problem werden. Egal ob interessierte Kunden, die mehr wissen wollen, oder bestehende Nutzer, die einen Fehler melden wollen: Man muss immer effizient mit ihnen kommunizieren können. Wenn ein Startup wächst, wird häufig versucht, den Zeitaufwand für jeden einzelnen Interessenten so gering wie möglich zu halten, indem man Chatbots einsetzt, um Interessenten anzusprechen, Hilfszentren für FAQs einzurichten und Standardantworten für E-Mails festzulegen.

Die Hauptschwierigkeiten für Start-ups bestehen dann meist darin

- als Marke vertrauenswürdig und in der gesamten Kommunikation konsistent zu sein und

- den Überblick über alle Kunden zu behalten, indem festgehalten wird, wer mit ihnen spricht und was gesagt wurde.

Front ermöglicht dies durch eine Reihe von Tools, die es einem Team von Kundenservice- oder Vertriebsmitarbeitern ermöglichen, jedem Kontakt bestimmte Personen zuzuordnen und halbautomatische Antworten zu senden. Ziel ist es, die Kundenerfahrung zu verbessern, indem versucht wird, jeden mit einer tatsächlichen menschlichen Antwort zu versorgen (auch wenn hinter den Kulissen alle Vorgänge automatisiert sind). Durch die Möglichkeit, auf einem Account zusammenzuarbeiten und auf Nachrichten und E-Mails von einem Posteingang aus zu antworten, kann jeder innerhalb eines Teams einen Überblick darüber erhalten, wer und was kommuniziert wird. Front hat einen eigenen Blog, der zeigt, wie verschiedene Startups und Unternehmen das Tool nutzen.

Ähnliche Tools: Zendesk, Freshdesk

Der Autor Richard O'Grady stammt ursprünglich aus London, wo er innerhalb der Start-up-Szene vor allem digitale Produkte aufbaute, und kam dann nach Berlin – ursprünglich, um selbst Programmieren zu lernen. Seit mehr als zwei Jahren ist er nun Country Manager, Germany - Le Wagon, Deutschland.

Diese Artikel könnten Sie auch interessieren:

„Wir scheitern nicht an der Technologie, sondern an der Kommerzialisierung“

Warum wandern Europas DeepTech-Gründer*innen ab? Wie viel Schuld trägt das europäische Ökosystem daran – und wie viel die Gründer*innen selbst? Im Interview: Dr. Martin Schilling, Ex-N26-COO und CEO von Deep Tech Momentum, über fehlendes Risikokapital, mangelnde Traktion und den schweren Weg zur Skalierung.

Deutschland und Europa sind starke Quellen für DeepTech-Innovationen – aus Universitäten, Forschungseinrichtungen, Patenten und technischer Domänenexpertise. Dass wir hier in der Spitzenliga spielen, belegen Studien wie das European Innovation Scoreboard, des Europäischen Patentamts und der Max-Planck-Gesellschaft regelmäßig. Dennoch stehen wir vor einem massiven Problem: Es mangelt nicht an Innovationen selbst, sondern an ihrer Kommerzialisierung. Im Vergleich zu den USA, wo Investor*innen häufig früher und mit höherer Risikobereitschaft auf große technologische Wetten setzen, finden europäische Start-ups zu spät Kund*innen, Traktion und risikofreudiges Kapital. Weil Kommerzialisierung, Industrialisierung und Wachstum hierzulande oft langsamer verlaufen, entsteht für viele Gründer*innen ein struktureller Druck, Kapital und Skalierung in den USA zu suchen.

Einer, der diese Lücke an der Schnittstelle von Gründer*innen, Kapital und Unternehmenskunden aus erster Hand beobachtet, ist Dr. Martin Schilling. Der ehemalige COO von N26 und Managing Director von Techstars Berlin ist heute Co-Founder und CEO von Deep Tech Momentum (DTM). DTM ist Europas führende Plattform für DeepTech und AI Innovation, findet vom 20. bis 21. Mai 2026 in Berlin statt und bringt Unternehmen als potenzielle Kund*innen, DeepTech-Start-ups als Anbieter*innen und Investor*innen aktiv zusammen.

Wir wollten von Martin Schilling erfahren: Wie viel Schuld trägt das europäische Ökosystem an der geschilderten Misere – und wie viel die Gründer*innen selbst?

StartingUp: Martin, du stellst die These auf, es mangele in Europa nicht an DeepTech-Innovationen, sondern an der Kommerzialisierung. Machen wir es uns damit nicht zu einfach? Müssten wir nicht ehrlicherweise auch über die katastrophal langsamen IP-Transfer-Prozesse an deutschen Universitäten, überregulierte Märkte und den Fachkräftemangel sprechen, die Start-ups schon abwürgen, bevor sie überhaupt etwas kommerzialisieren können?

Martin Schilling: Ich glaube, wir dürfen uns hier nichts vormachen. Natürlich haben wir in Europa strukturelle Probleme wie langsame IP-Transfer-Prozesse, fragmentierte Märkte, Regulierung, Fachkräftemangel. Das alles ist real und bremst viele Entwicklungen aus. Aber diese Faktoren erklären nicht vollständig, warum wir trotz exzellenter Forschung so selten globale Kategorie-Gewinner hervorbringen.

Der entscheidende Punkt ist aus meiner Sicht ein anderer: In Europa denken wir Technologie oft zu lange aus der Perspektive der Forschung und zu spät aus der Perspektive des Marktes. In den USA wird viel früher gefragt: Wer zahlt dafür? Wie schnell kommen wir in echte Deployment-Szenarien? In Europa fragen wir zu lange, ob die Technologie perfekt ist. Das führt dazu, dass viele DeepTech-Start-ups zu spät mit echten Kunden interagieren, zu spät lernen und zu spät Traktion aufbauen. Die strukturellen Themen sind ein Teil des Problems. Aber die Art, wie wir Unternehmen bauen und die fehlende frühe Kommerzialisierungslogik sind aus meiner Sicht größere Hebel.

StartingUp: Du hast als COO bei N26 massives Wachstum miterlebt – ein B2C-FinTech mit einer App. DeepTech bedeutet aber oft jahrelange Forschung, Hardware-Entwicklung, Patente und B2B-Sales-Zyklen, die ewig dauern. Wie viel B2C-Wachstums-Mindset lässt sich überhaupt auf hochkomplexe DeepTech-Unternehmen übertragen, ohne an der Realität zu scheitern?

Martin Schilling: Man kann DeepTech nicht wie ein B2C-FinTech skalieren. Das wäre naiv. Die Zyklen sind länger, die Kapitalintensität höher, und die technische Unsicherheit ist real. Aber das heißt nicht, dass man auf ein Wachstums-Mindset verzichten kann. Was übertragbar ist, sind nicht die Taktiken, sondern die Prinzipien: Geschwindigkeit im Lernen, radikale Kundenorientierung und der Anspruch, früh zu skalieren und nicht erst, wenn alles perfekt ist.

Was ich oft sehe ist, dass DeepTech-Teams jahrelang die Technologie optimieren, bevor sie ernsthaft in den Markt gehen. In dieser Zeit verlieren sie wertvolle Iterationen. Die besten Teams denken von Anfang an in Dual Tracks: Technologie entwickeln und parallel kommerzielle Hypothesen testen. Das bedeutet nicht, dass man Hardware-Zyklen beschleunigen kann. Aber man kann sehr wohl beschleunigen, wie schnell man versteht, wo echter Bedarf ist und wie Zahlungsbereitschaft entsteht.

StartingUp: Ein ständiger Kritikpunkt ist, dass der Zugang zu mutigem Kapital in Europa langsamer funktioniert als in den USA. Aber VCs sind keine Wohlfahrtsverbände, sie rechnen Risiko und Rendite durch. Müssen wir nicht vielleicht zugeben, dass viele europäische DeepTech-Cases geschäftlich einfach nicht attraktiv oder zu schlecht gepitcht sind, um ein amerikanisches Risikoprofil anzuziehen?

Martin Schilling: Es ist zu einfach, alles auf fehlendes Kapital zu schieben. Ja, die USA haben mehr Kapital und mehr Risikoappetit. Aber Kapital folgt am Ende immer überzeugenden Geschichten und vor allem überzeugender Traktion. Was ich in Europa oft sehe: Technologisch brillante Teams, aber schwache Positionierung, unklare Go-to-Market-Strategien und zu wenig Fokus auf kommerzielle Meilensteine. Viele Pitches sind technisch beeindruckend, aber beantworten nicht die entscheidende Frage, warum aus etwas ein erfolgreiches Geschäftsmodell wird. Das heißt nicht, dass es kein strukturelles Kapitalproblem gibt. Das gibt es. Aber wir müssen genauso ehrlich sagen: Ein Teil des Problems liegt in der Art, wie wir DeepTech-Unternehmen bauen und erzählen.

StartingUp: Du beobachtest somit, dass deutsche Start-ups oft nicht an der Technologie, sondern an Marktanbindung und Traktion scheitern. Wenn die Technologie exzellent ist, scheitert es dann am Menschlichen? Wie oft erlebst du, dass brillante Forschende aus Eitelkeit nicht loslassen können und sich weigern, den CEO-Posten an erfahrene Business- und Sales-Profis abzugeben?

Martin Schilling: Das Thema gibt es, aber ich würde es differenzierter sehen. DeepTech entsteht oft aus wissenschaftlicher Exzellenz. Und diese Gründer*innen bringen etwas extrem Wertvolles mit: tiefes Verständnis, langfristiges Denken und eine hohe technische Vision. Die Herausforderung entsteht, wenn diese Stärken nicht durch kommerzielle Kompetenz ergänzt werden. Ich erlebe weniger ein klassisches „Ego-Problem“, sondern eher ein Rollenproblem, denn viele Gründer*innen haben nie gelernt, was es bedeutet, ein Unternehmen zu skalieren. Das gilt insbesondere im B2B-Kontext. Die besten Teams lösen das sehr pragmatisch. Sie bauen früh komplementäre Führungsteams mit starkem Sales-, Operations- und Marktverständnis auf. Ob das dann ein externer CEO ist oder nicht, ist zweitrangig. Entscheidend ist, dass die Organisation die Fähigkeiten hat, nicht nur Technologie zu entwickeln, sondern sie auch zu verkaufen.

StartingUp: Um Start-ups, Corporates und Investor*innen zusammenzubringen, veranstaltest du im Mai das Event Deep Tech Momentum in Berlin. Aber ganz ehrlich: Es gibt in Europa und Deutschland bereits hunderte Start-up-Konferenzen, Summits und Matchmaking-Events. Warum sollte ausgerechnet ein weiterer Marktplatz das tiefgreifende strukturelle Problem lösen, dass die deutsche Industrie oft schlichtweg zu risikoavers ist, um bei jungen Start-ups einzukaufen?

Martin Schilling: Ich stimme dir zu. Es mangelt nicht an Events in Europa, wir haben eher zu viele davon. Der Unterschied bei Deep Tech Momentum ist, dass wir kein klassisches Konferenzformat sind, sondern ein Marktplatz. Was heißt das konkret? Wir bringen nicht einfach Leute zusammen, sondern orchestrieren konkrete Interaktionen zwischen Start-ups, Corporates und Investor*innen. Dabei verfolgen wir das klare Ziel, Deals, Partnerschaften und Deployment zu schaffen.

Bei Deep Tech Momentum kommen über 3.000 Senior Entscheider*innen zusammen. Über den Marktplatz wurden bereits mehr als 500 Millionen Euro an Investitionen und hunderte Partnerschaften angestoßen. Unser Ziel bis 2030 ist es, 100 Milliarden Euro zusätzliche DeepTech-Investitionen zu mobilisieren und 10.000 Partnerschaften zwischen Start-ups und Industrie zu ermöglichen.

Ein Beispiel ist unser Guardian Program. Dort bringen wir die Top 300 Senior Innovation Leaders aus führenden Unternehmen gezielt mit vorqualifizierten DeepTech-Start-ups zusammen, also mit Unternehmen, die echte Budgets, konkrete Anwendungsfälle und Entscheidungsmandate mitbringen. Damit packen wir aus meiner Sicht das Kernproblem Europas an: Wir verschaffen Zugang zu ersten Kunden und realen Anwendungen.

StartingUp: Durch langsames Wachstum entsteht ein Druck auf Gründer*innen, in die USA auszuweichen. Dort lockt der Markt gezielt mit Milliarden-Subventionen und schnellem Kapital. Was entgegnest du einem DeepTech-Gründer, der heute zu dir sagt: „Herr Schilling, Europa ist nett für die Forschung, aber um ein Einhorn zu bauen, muss ich sofort in die USA?“

Martin Schilling: Ich würde niemandem pauschal davon abraten, in die USA zu gehen. Für viele Modelle ist das absolut sinnvoll, gerade wenn es um Kapital und Marktskalierung geht. Aber ich würde zwei Dinge entgegnen. Erstens: Europa ist kein schlechter Ort, um ein DeepTech-Unternehmen zu bauen. Wir haben exzellente Forschung, starke Industriepartner und zunehmend auch Kapital. Zweitens – und wichtiger: Der Engpass ist oft nicht der Standort, sondern die Geschwindigkeit, mit der man Kommerzialisierung erreicht. Wenn ein Start-up es schafft, früh echte Kunden zu gewinnen, Piloten zu fahren und Umsatz aufzubauen, dann wird Kapital folgen, auch in Europa. Mit Deep Tech Momentum möchten wir den Weg von Technologie zur Anwendung beschleunigen. Denn es geht nicht um Europa vs. USA. Es geht darum, ob ein Unternehmen es schafft, aus Technologie ein funktionierendes Geschäft zu machen.

Danke, Martin Schilling, für die spannenden Insights

Das Interview führte StartingUp-Chefredakteur Hans Luthardt

5 Mio. Euro für die „Schreibtischlosen“: Kann Elephant den Frontline-Markt wirklich digitalisieren?

Operative Teams in der Produktion, der Logistik oder im Service gelten bei der Digitalisierung oft als vernachlässigt. Das Berliner Start-up Elephant verspricht Abhilfe durch KI-gestütztes Micro-Learning und sicherte sich dafür nun 5 Millionen Euro. Doch zwischen dem PR-Versprechen und der harten Shopfloor-Realität warten ein eng besetzter Markt und die Gefahr der technologischen Austauschbarkeit.

Die aktuelle Finanzierungsrunde wird von den Corporate-Venture-Capital-Einheiten (CVC) EnBW New Ventures und Wepa angeführt. Dass ausgerechnet diese Player investieren, ist kein Zufall: Die Mutterkonzerne steuern selbst riesige operative Belegschaften. Sie dienen der Elephant Technologies GmbH somit nicht nur als Geldgeber, sondern gleichzeitig als Testlabor und Referenzkund*innen. Ergänzt wird die Runde durch namhafte Angel-Investoren aus dem Umfeld von Flix und Home24.

Das Geschäftsmodell: KI-Kurse gegen das „Wissens-Leck“

Die Gründer Maurice Zomorrodi, Niklas Dehio und Melchior Schramm riefen Elephant im Sommer 2022 ins Leben. Sie adressieren ein strukturelles Problem: Wissen wird in operativen Betrieben oft noch mündlich oder über veraltete Handbücher weitergegeben. Die Elephant-Plattform nutzt einen KI-gestützten „Coursebuilder“, um aus bestehenden Dokumenten mit wenigen Klicks interaktive Lerneinheiten für eine mobile App zu generieren. Ein KI-Assistent soll Fragen zudem kontextbezogen direkt am Arbeitsplatz beantworten. Um Sprachbarrieren in der Industrie abzubauen, bietet das System Übersetzungen in über 95 Sprachen. Dass das Modell Anklang findet, zeigt sich am Solar-Einhorn Enpal, das Elephant zur Schulung von Quereinsteigern nutzt.

Journalistisch betrachtet muss man jedoch das Preisschild hinterfragen: Der Einstieg in die Plattform beginnt bei 640 Euro monatlich für bis zu 50 Nutzer*innen („Team“) und skaliert über 1.300 Euro („Pro“) bis hin zu Enterprise-Lösungen ab 4.000 Euro im Monat. Für Mittelständler*innen ist das ein beachtlicher Kostenblock, der sich zügig durch messbar sinkende Fehlerquoten oder kürzere Onboarding-Zeiten rechtfertigen muss.

Ein Markt im Goldrausch: Wer sind die Jäger*innen?

Elephant ist längst nicht allein auf der Jagd nach der „Deskless Workforce“. Dieses enorme Segment hat in den letzten Jahren mächtige Wettbewerber auf den Plan gerufen. So hat beispielsweise der Branchen-Riese Beekeeper die Frontline-Trainingsplattform eduMe nahtlos in seine App integriert, um Mitarbeitenden Weiterbildung mit nur einem Klick zugänglich zu machen. Solche Konsolidierungen zeigen: Der Standard im operativen Weiterbildungsmarkt wird zunehmend höher.

Zwischen Innovation und Commodity

Trotz des Kapitalschubs steht das Start-up vor zwei entscheidenden Hürden. Erstens droht der technologische Kern – das Umwandeln von PDFs in Quizze mittels KI – zu einer reinen „Commodity“ zu werden. Da große Sprachmodelle (LLMs) rasant mächtiger werden, könnten generische Unternehmenstools diese Funktion bald als Standard-Feature mitliefern. Elephant muss beweisen, dass sich die Plattform unverzichtbar tief in echte Qualitätssicherungs- und Produktionsprozesse verwebt.

Zweitens bleibt der Faktor Mensch das größte Risiko. Software für den Shopfloor scheitert selten am Management, sondern oft an der fehlenden Akzeptanz der Belegschaft. Wenn die App im stressigen Arbeitsalltag nicht als spürbare Entlastung wahrgenommen wird, nützt auch die beste KI wenig.

Unser Fazit

Ein valider Ansatz unter hohem Konkurrenzdruck Elephant hat mit EnBW und Wepa die idealen Partner gefunden, um die Praxistauglichkeit in großen Strukturen unter Beweis zu stellen. Die 5 Millionen Euro geben den nötigen Runway. Dennoch ist der technologische Burggraben schmal. Um langfristig gegen internationale Schwergewichte zu bestehen, muss Elephant mehr sein als nur ein komfortabler Content-Generator. Der echte Härtetest beginnt an der Werkbank.

Von Streaming bis Gaming – Diese Branchen profitieren vom digitalen Nutzerverhalten

Wie On-Demand-Modelle Branchen prägen und welche Erfolgsfaktoren Gründer jetzt kennen müssen.

Inhalte, Dienstleistungen und Unterhaltung werden zunehmend flexibel, mobil und individuell konsumiert. Während früher feste Zeiten und physische Angebote dominierten, stehen heute On-Demand-Modelle im Mittelpunkt. Diese Entwicklung wirkt sich nicht nur auf einzelne Produkte aus, sondern prägt ganze Branchen und schafft neue wirtschaftliche Dynamiken. Insbesondere digitale Geschäftsmodelle profitieren von der steigenden Erwartung an Verfügbarkeit, Geschwindigkeit und Personalisierung.

Digitales Nutzerverhalten im Wandel

Die Verschiebung der Nutzungsgewohnheiten von stationären Desktop-Lösungen hin zu mobilen Endgeräten ist der stärkste Treiber der aktuellen Digitalökonomie. On-Demand ist zum Standard geworden: Ob Content, Services oder Unterhaltung – die Erwartungshaltung der Konsumenten ist geprägt von sofortiger Verfügbarkeit und einer hohen Passgenauigkeit durch Personalisierung.

- Inhalte jederzeit abrufbar: Die zeitliche Entkopplung von linearen Sendeplänen oder Öffnungszeiten.

- Omnichannel-Nutzung: Ein nahtloser Übergang zwischen Smartphone, Tablet, Smart-TV und Laptop.

- Komfort als Zahlungsargument: Eine wachsende Bereitschaft, für Zeitersparnis und einfache Bedienbarkeit Abonnements abzuschließen.

Streaming als Vorreiter der digitalen Transformation

Streaming-Dienste gelten als eines der prägendsten Beispiele für die Anpassung an modernes Nutzerverhalten. Klassische Medienformate wurden durch Plattformen ersetzt, die Inhalte jederzeit zugänglich machen. Gleichzeitig haben sich abonnementbasierte Modelle etabliert, die stabile und planbare Einnahmen ermöglichen.

Ein zentraler Erfolgsfaktor liegt in der Nutzung von Daten. Algorithmen analysieren das Verhalten der Nutzer und liefern personalisierte Empfehlungen, wodurch die Verweildauer und Kundenbindung gesteigert werden. Für Unternehmen ergibt sich daraus ein skalierbares Modell, das sich international ausrollen lässt und kontinuierlich optimiert werden kann. Die Grenzkosten pro neuem Nutzer sind minimal. Eine starke Kundenbindung erfolgt hier primär durch exklusiven Content und ein personalisiertes Interface.

In diesem Bereich steht allerdings eine Wende bevor. Durch die große Akzeptanz und Nachfrage sind zahlreiche Angebote und dadurch ein fragmentierter Markt entstanden. Mehrere Abos pro Haushalt sind die Regel und Nutzer wünschen sich zunehmend eine Bündelung.

Gaming und interaktive Unterhaltung auf dem Vormarsch

Gaming hat sich von einer Nische zu einem der weltweit größten digitalen Märkte entwickelt und übertrifft in den Umsätzen längst die Film- und Musikindustrie zusammen. Besonders entscheidend ist hier der soziale Aspekt: Community-Building innerhalb der Spielewelten macht Gaming zu einem sozialen Netzwerk. Der Übergang zu Live-Events und Multiplayer-Erlebnissen schafft eine emotionale Bindung, die weit über das reine Konsumieren hinausgeht.

Gleichzeitig verschiebt sich der Fokus von einmaligen Käufen hin zu kontinuierlichen Einnahmequellen, etwa durch In-Game-Käufe oder abonnementbasierte Modelle. Diese Entwicklung zeigt, wie stark Nutzererlebnisse und soziale Komponenten den Erfolg digitaler Angebote beeinflussen.

iGaming als Teil der digitalen Entertainment-Ökonomie

Innerhalb der digitalen Unterhaltungslandschaft nimmt auch der iGaming-Bereich eine besondere Rolle ein. Dieser Sektor profitiert in ähnlicher Weise von technologischen Entwicklungen wie Streaming und Gaming, insbesondere durch mobile Nutzung, intuitive Benutzeroberflächen und schnelle Transaktionsmöglichkeiten.

Die Plattformen sind darauf ausgelegt, ein möglichst reibungsloses und immersives Nutzererlebnis zu bieten. Online Casino Schweiz präsentiert eine klare Strukturierung unterschiedlicher Games sortiert nach Themen oder Anbietern. Above the fold finden Nutzer Infos zu aktuellen Top-Gewinnern, Verlosungs-Aktionen oder neuen Titeln. Die Kombination aus Gamification-Elementen, internationaler Skalierbarkeit und datenbasierter Optimierung macht diesen Markt aus wirtschaftlicher Perspektive besonders interessant.

Typische Merkmale dieser Branche sind:

- hohe Nutzerbindung durch spielerische Elemente

- globale Ausrichtung digitaler Plattformen

- kontinuierliche Anpassung durch Nutzerdaten

Wirtschaftlichkeit und Transferpotenzial

Die Branche zeichnet sich durch überdurchschnittlich hohe operative Margen aus, da nach der initialen Entwicklung der Plattform und der Integration von Content die Skalierungskosten gering bleiben. Während Marketing- und Lizenzkosten substanziell sind, ermöglichen automatisierte Prozesse in der Kundenverwaltung und Zahlungsabwicklung eine hohe Profitabilität.

Diese Effizienz lässt sich auf andere digitale Angebote übertragen: Das Prinzip der Mikro-Interaktionen und die sofortige Belohnung (Instant Gratification) sind Mechanismen, die auch im E-Commerce oder in Produktivitäts-Apps die Conversion-Rate steigern. Wer lernt, die im iGaming perfektionierten Methoden der Datenanalyse und Echtzeit-Personalisierung zu nutzen, kann die Kundenbindung in nahezu jedem digitalen Geschäftsmodell signifikant erhöhen.

Was Gründer daraus lernen können

Die Analyse erfolgreicher digitaler Branchen zeigt klare Muster. Im Mittelpunkt steht nicht die Technologie selbst, sondern deren Anwendung im Kontext realer Nutzerbedürfnisse. Plattformdenken, Datenanalyse und eine konsequente Ausrichtung auf Benutzerfreundlichkeit sind zentrale Erfolgsfaktoren.

Konkrete Impulse:

- Verhalten statt Produkt: Geschäftsmodelle sollten dort ansetzen, wo Nutzer bereits Zeit verbringen oder Reibungsverluste erleben.

- Iteration: Schnelles Testing von Funktionen (MVP-Ansatz) ermöglicht es, am Puls der Zielgruppe zu bleiben.

- Mobile-First-Denkweise: Jede Lösung muss primär auf dem kleinsten Bildschirm perfekt funktionieren.

- Entwicklung skalierbarer Plattformlösungen

Das digitale Nutzerverhalten entwickelt sich dynamisch weiter und beeinflusst zahlreiche Branchen nachhaltig. Unternehmen, die diese Veränderungen frühzeitig erkennen und in ihre Strategien integrieren, sichern sich entscheidende Wettbewerbsvorteile. Besonders erfolgreich sind Modelle, die Flexibilität, Personalisierung, einfache Zugänglichkeit und die Einbindung in starke App-Ökosysteme miteinander verbinden. In einer zunehmend digitalen Wirtschaft entstehen neue Chancen vor allem dort, wo technologische Möglichkeiten auf veränderte Erwartungen treffen.

Weitere Gewinner des Nutzerwandels

Neben Unterhaltung und Gaming profitieren auch andere Branchen vom veränderten Verhalten. Besonders deutlich wird dies in Bereichen, die auf flexible Nutzung und personalisierte Angebote setzen.

Dazu zählen unter anderem:

- E-Learning-Plattformen, die ortsunabhängiges Lernen ermöglichen

- Fitness- und Gesundheits-Apps, die individuelle Trainingspläne bieten

- Fintech-Lösungen, die schnelle und unkomplizierte Zahlungsprozesse unterstützen

Gemeinsam ist diesen Geschäftsmodellen eine starke Nutzerzentrierung. Sie bieten Lösungen, die sich nahtlos in den Alltag integrieren lassen und dabei individuelle Bedürfnisse berücksichtigen.

Was Gründer daraus lernen können

Der entscheidende Erfolgsfaktor in der digitalen Ökonomie ist die radikale Nutzerzentrierung. Erfolgreiche Unternehmen denken nicht mehr in isolierten Produkten, sondern in Plattformen, die ein Problem ganzheitlich lösen. Die Bedeutung von Datenanalyse zur stetigen Verbesserung der UX kann dabei nicht überschätzt werden.

Die Verfestigung digitaler Gewohnheiten ist ein unumkehrbarer Prozess. Neue Märkte werden dort entstehen, wo technologische Möglichkeiten auf neue menschliche Bedürfnisse treffen. Die größten Chancen liegen für Gründer und etablierte Unternehmen dort, wo sich das Nutzerverhalten schneller wandelt als die bestehenden, oft noch trägen Angebote am Markt.

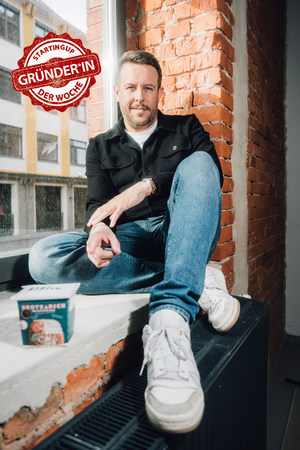

Gründer*in der Woche: Brotrausch – Premium-Teig im recycelten Messbecher

Backen ohne Frust: Wie Brotrausch mit smarten Premium-Mischungen im recycelbaren Messbecher den hart umkämpften DIY-Brotmarkt aufmischen will.

Hinter der 2022 ins Leben gerufenen Marke Brotrausch, die 2023 offiziell an den Start ging, steht heute die Bremer Brot GmbH. Das Unternehmen hat die Marke im Jahr 2025 durch einen Asset Deal übernommen. An der Spitze des Start-ups steht ein Gründer, dessen Wurzeln weit abseits des klassischen Bäckerhandwerks liegen. Philipp Herrnberger, einst in der Sportvermarktung bei Werder Bremen tätig, gründete nicht aus einer entspannten Laune heraus, sondern aus gesundheitlichen Gründen. Nach dem Konsum von herkömmlichem Industrie-Brot kämpfte er immer wieder mit Beschwerden. Sein Antrieb: Ein bekömmliches, transparentes Brot ohne Zusatzstoffe zu kreieren, das man ohne Vorwissen einfach selbst backen kann.

Der Sprung aus der Agenturwelt in die Food-Szene war unkonventionell, doch genau das habe dem Team geholfen, „Dinge anders zu denken“, erinnert sich Herrnberger. In der ersten Phase finanzierte sich das anfänglich fünfköpfige Gesellschafterteam komplett aus eigenen Mitteln. Der Mix aus Bäckermeister, Kaufmann und Kreativen brachte dabei entscheidende Vorteile: „Wir konnten uns voll auf Produkt und Marke konzentrieren, ohne von Anfang an von externen Erwartungen getrieben zu sein“, erklärt der Geschäftsführer. Dennoch räumt er rückblickend offen ein, dass der Bootstrapping-Ansatz an seine Grenzen stieß. „Unter dem Strich muss man sagen, dass wir es ohne externe Investoren nicht geschafft haben“, resümiert Herrnberger über den rettenden Asset-Deal und Neustart im Sommer 2025.

Premium-Teig im recycelten Messbecher

Das Geschäftsmodell hebt sich bewusst vom preissensiblen Massenmarkt ab und richtet sich an all jene, denen im Post-Corona-Alltag schlichtweg die Zeit für aufwändige Sauerteig-Experimente fehlt. Hier setzt das Start-up mit absoluter Convenience an: Die neun natürlichen Brotmischungen erfordern laut Hersteller keinerlei Backerfahrung, kommen gänzlich ohne Küchenmaschine aus und beschränken sich auf rund zehn Minuten aktive Arbeitszeit. Die Zutaten für die „Made in Germany“-Strategie stammen aus kontrolliertem, regionalem Anbau.

Raffiniert und praktisch zugleich ist die Verpackungslösung: Die Mischungen ruhen in einem PET-Becher, der direkt als exakter Messbecher für die benötigte Wasserzugabe dient. Doch gerade ein Plastikbecher weckt in der nachhaltigkeitsgetriebenen Zielgruppe oft Skepsis. Herrnberger verteidigt die Entscheidung leidenschaftlich und verweist auf das rigorose Ausschlussverfahren in der Produktentwicklung. „Kraftpapiertüten sehen offensichtlich nachhaltig aus, wenn sie aber wie für uns beschichtet wären, können sie nur noch verbrannt werden“, kontert der Gründer. Dies sei überhaupt nicht im Sinne der Ressourcenschonung. Stattdessen setzt Brotrausch auf einen vollständig aus recyceltem PET bestehenden Becher einer deutschen Firma. Da die Pappbanderole raffiniert „einschnappt“ und nicht geklebt wird, seien beide Komponenten zu 100 Prozent wiederrecycelbar. Damit sei die Marke auch fit für zukünftige rechtliche Verpackungsvorschriften.

Smarte Nischen und margenstarkes Upselling

Anstatt den oft verlustreichen Preiskampf im regulären Supermarktregal zu suchen, etabliert sich Brotrausch konsequent als D2C-Marke im Premium-Segment. Eine reguläre Brotbackmischung schlägt mit 5,99 Euro zu Buche – eine echte Ansage für ein Produkt, in das die Kundschaft noch Strom, Wasser und Arbeitszeit investieren muss.

„Auf den ersten Blick wirkt der Preis natürlich hoch, vor allem, wenn man ihn rein mit Mehl vergleicht“, gibt Herrnberger zu bedenken. Dieser Vergleich greife jedoch zu kurz. „Wir verkaufen kein Rohprodukt, sondern ein durchdachtes Gesamterlebnis“, betont er und verweist auf die raffinierten Rezepturen und Prozesse, die zu einem Resultat führen, „das viele so zuhause sonst nicht hinbekommen würden“. Die Preisakzeptanz misst das Unternehmen primär über das Feedback und das Kaufverhalten. Als Kund*innen begannen, nicht nur ein zweites Mal zu bestellen, sondern direkt größere Pakete und mehrere Sorten in den Warenkorb legten, wusste das Team: Der Markt akzeptiert den Premium-Aufschlag. Zudem stellt Herrnberger klar: „Im Übrigen kostet das Backen im heimischen und relativ neuen Backofen keine 25 Cent.“

Aus den regulären Supermärkten hat sich Brotrausch mittlerweile bewusst zurückgezogen, da der Kampf um die Regale dort stark über den Preis diktiert wird. „Wir fokussieren uns nun auf Genusspartner wie Weinhändler, Hofläden oder Feinkosthändler, bei denen die Preise hochwertiger Produkte eher akzeptiert werden“, erklärt der Geschäftsführer den strategischen Kurswechsel.

Um die ambitionierte Preisgestaltung zu rechtfertigen, inszeniert das Start-up seine Produkte gezielt als Lifestyle-Upgrade – etwa für das autarke Vanlife beim Camping, als Mitbringsel zum Grillen oder für den Osterbrunch. Flankiert wird das Kernsortiment durch ein lukratives Upselling-Portfolio, das von stilvollen Geschenkboxen für knapp 30 Euro bis hin zu speziellen Baguette-Backblechen, Fruchtaufstrichen und Stullensalzen reicht. Diese Zusatzartikel seien laut Herrnberger zwar nicht essenziell für das Überleben des Unternehmens, da das Brotbacken der Mittelpunkt bleibe, sie seien aber entscheidend für das Wachstum. „Im E-Commerce geht es um den durchschnittlichen Warenkorb und die Retention“, analysiert der Gründer. Das Zusatzsortiment mache das „Erlebnis Brot“ noch intensiver. Der Umsatzanteil dieser lukrativen Extras liegt aktuell bei knapp 15 Prozent.

Die Gretchenfrage der Kund*innenbindung

Dieser strategische Ansatz sichert gesunde Margen und entzieht die Marke geschickt der Vergleichbarkeit mit Discountern. Dennoch bleibt eine große Herausforderung: Der Markt für DIY-Lebensmittel ist durch starke Bio-Traditionsmarken massiv umkämpft. Die größte Hürde besteht darin, die Wiederkaufsrate auf einem profitablen Niveau zu halten. Denn wenn die stylische Mischung primär als originelles Präsent zum Vatertag verschenkt wird, fehlen dem Unternehmen am Ende die wiederkehrenden Alltagsumsätze.

Einen aggressiven Rollout in den stationären Einzelhandel schließt Herrnberger vorerst aus. Dies sei nur mit hohen Investitionen machbar und berge das Risiko, zu einem „One-Hit-Wonder“ zu verkommen. Die Devise lautet stattdessen: „Wir wollen gesund wachsen, um profitabel zu werden.“ Die Geschenkboxen spielen in dieser Strategie eine überraschende Doppelrolle. Sie treffen nicht nur den Zeitgeist, sondern fungieren als cleverer Akquise-Kanal. „Wir erreichen dadurch Menschen, die uns vielleicht noch nicht kennen und unmittelbar mit der Marke, der Qualität und dem Erlebnis in Berührung kommen“, freut sich Herrnberger. Auf diese Weise spare man sich enorme Kund*innenakquisitionskosten. Zudem entwickle sich das Geschenke-Segment zunehmend zu einem echten Profitcenter im B2B-Bereich – etwa wenn Immobilienmakler die Boxen zur Hausübergabe als modernes „Brot und Salz“-Präsent nutzen.

Trotz der starken Nischen-Performance ist klar: Brotrausch muss langfristig beweisen, dass das Premium-Brot aus dem Becher nicht nur an Feiertagen verschenkt wird, sondern den dauerhaften Sprung in die alltägliche Frühstücksroutine der Konsument*innen schafft.

Gründer*in der Woche: SIRPLUS – Überlebenskampf im Food-Outlet-Markt

Während der millionenschwere Rivale Motatos aus Deutschland flieht, schreibt ein einstiger Sanierungsfall plötzlich schwarze Zahlen. Wie unser(e) Gründer*in der Woche – das Berliner Social Business SIRPLUS von Raphael Fellmer – vom gehypten Start-up zum krisenerprobten Mittelständler reifte.

Das Berliner Social Business SIRPLUS hat bewegte Jahre hinter sich. Nach einer überstandenen Insolvenz 2024 erfindet sich das ehemalige Vorzeige-Start-up um Gründer Raphael Fellmer aktuell neu – und setzt auf Community statt auf klassisches VC-Kapital. Mitten in diese Konsolidierungsphase platzt im April 2026 der Deutschland-Rückzug des Konkurrenten Motatos. Ein Lehrstück über die harten Grenzen des Skalierens und den schmerzhaften Weg vom gehypten Start-up zum krisenerprobten Mittelständler.

Paradoxon im Food-Markt: Der Sanierungsfall überlebt den Giganten

Es ist eine Nachricht, die in der hiesigen FoodTech-Szene aktuell für ein mittelschweres Beben sorgt: Der schwedische Online-Discounter Motatos zieht sich aus Deutschland zurück. Trotz rund 300.000 aktiven Kund*innen und einem beachtlichen Jahresumsatz von über 35 Millionen Euro zieht das Unternehmen Mitte April 2026 die Reißleine. Das Deutschland-Geschäft blieb hochgradig defizitär. Die Begründung: Man wolle sich auf das profitable Wachstum in den nordischen Heimatmärkten konzentrieren. Dieser Rückzug wirft ein grelles Licht auf die strukturellen Herausforderungen des deutschen Lebensmittelmarkts. Doch während der finanzstarke Konkurrent aus dem Norden kapituliert, hält ausgerechnet das Berliner Unternehmen SIRPLUS die Stellung – ein Turnaround-Case, der erst vor Kurzem selbst am Abgrund stand.

Warum überlebt SIRPLUS dort, wo ein millionenschwerer Riese aufgibt? Gründer Raphael Fellmer macht sich keine Illusionen über das Marktumfeld. „Wir haben in Deutschland wohl einen der härtesten umkämpften Lebensmittelmärkte in der EU“, analysiert er die Lage. Dass nach dem US-Giganten Walmart nun mit Motatos der nächste Konzern den Rückzug antrete, sei bezeichnend. Die eigene Überlebensstrategie liege in den Lehren der bitteren Vergangenheit. „Wir haben bei SIRPLUS 2.0 einen so radikalen Pivot hingelegt, wie ich es nicht für möglich gehalten hätte“, betont der Gründer. Das Erfolgsrezept liege heute nicht mehr in der reinen Größe, sondern in extremer Agilität und einem strikten Fokus auf organisches Wachstum. Die Rechnung scheint aufzugehen: Auch wenn die Berliner rund 20-mal weniger Umsatz machen als der scheidende Konkurrent Motatos, schreiben sie laut Fellmer bereits schwarze Zahlen. Für 2026 kündigt er erstmals seit der Gründung mehr Einnahmen als Ausgaben an.

„Das entlastet mich persönlich sehr, weil ich seit Jahren im Dauerfunding-Modus bin.“

Raphael Fellmer über die ersten schwarzen Zahlen seit der Gründung 2017

„Wir sind nicht per Du“: Wenn Purpose auf Realität prallt

Die Geschichte von SIRPLUS ist untrennbar mit seinem prominenten Gründer verbunden. Der Klimaaktivist erlangte Bekanntheit, weil er aus Protest gegen die Wegwerfgesellschaft fünfeinhalb Jahre lang komplett ohne Geld lebte und sich durch „Containern“ ernährte. Nach dem Aufbau der Foodsharing-Initiative folgte 2017 gemeinsam mit Martin Schott die Gründung von SIRPLUS. Das Kern-Geschäftsmodell: Das Unternehmen rettet bei Produzent*innen und Großhändler*innen überschüssige Ware – etwa wegen nahendem Mindesthaltbarkeitsdatum (MHD), Überproduktionen oder Verpackungsfehlern – und verkauft diese D2C (Direct-to-Consumer) über den eigenen Online-Shop mit Rabatt an Endkund*innen.

Damals griff das Team mit diesem Konzept nach den Sternen des klassischen Start-up-Wachstums. Doch der Spagat zwischen Weltverbesserung und knallhart skalierbarem E-Commerce erwies sich als tückisch. Das zeigte sich eindrücklich im September 2019 bei einem denkwürdigen Auftritt in der TV-Show Die Höhle der Löwen. Fellmer und Schott forderten 700.000 Euro für 6 Prozent der Anteile – was einer überaus ambitionierten Firmenbewertung von fast 11,7 Millionen Euro entsprach.

Die Kombination aus Social-Impact-Rhetorik und massiver kapitalistischer Bewertung sorgte für einen beispiellosen Eklat. Investor Georg Kofler warf dem Duo „moralisierendes Schöngerede“ vor. Als die Gründer sich rechtfertigen wollten und Kofler dabei duzten, unterbrach dieser scharf mit einem Satz, der in die deutsche TV-Geschichte einging: „Wir sind nicht per Du. Unter Multimillionären ist man eine Weile per Sie.“ Das Team verließ das Studio ohne Deal. Die Investoren hatten den wunden Punkt getroffen: Ein gesellschaftliches Problem moralisch aufzuladen, heilt keine schwachen Unit Economics.

Rückblickend gibt sich Fellmer geläutert, verhehlt aber auch seine damalige Verletztheit nicht. Die Einladung zur Show habe man primär angenommen, um Reichweite für das Thema Lebensmittelverschwendung zu generieren. „Dass wir so stark kritisiert und vor allem auch persönlich angegriffen würden, hätte ich mir nicht vorstellen können“, gibt er unumwunden zu. Die völlig überzogene Firmenbewertung rechnet er heute der eigenen Naivität an: „Wir kannten uns nicht aus und waren glücklich darüber – ohne zu verstehen, dass eine zu hohe Bewertung auch hinderlich sein kann.“

Der harte Cut: Vom 90-Köpfe-Team zum Sanierungsfall

Die Kritik der Löwen sollte sich in gewisser Weise als prophetisch erweisen. Das Geschäftsmodell erfordert es, schwere, niedrigpreisige Güter aufwendig zu lagern, zu kommissionieren und per Paketdienst zu verschicken. Die Logistikkosten fraßen die Margen auf. Als Ende 2023 im ohnehin schwierigen Marktumfeld eine rettende Finanzierungsrunde platzte, musste SIRPLUS im Januar 2024 Insolvenz anmelden. Und das, obwohl das Team von ehemals rund 90 auf unter 30 Mitarbeitende Monate vor der Pleite radikal eingedampft wurde. Die verlustreichen stationären „Rettermärkte“ gehörten schon zwei Jahre zuvor der Vergangenheit an. Im Mai 2024 gelang zwar die Rettung durch drei Viertel der Bestandsinvestor*innen, doch der Preis war hoch: Aus dem einstigen Hyper-Wachstums-Narrativ wurde ein harter Überlebenskampf. SIRPLUS wurde zeitweise vom gehypten Start-up zum Sanierungsfall.

„Es war sehr hart, nach sieben Jahren Kampf anzuerkennen, dass wir es einfach nicht geschafft haben, wirtschaftlich zu werden.“

Raphael Fellmer über den Tiefpunkt vor dem Neustart

Der personelle Aderlass ging an die Substanz. Zwischenzeitlich kämpfte der Gründer praktisch allein, mit seinem Bruder als einzigem Mitarbeiter. Dennoch sei sein Wille ungebrochen gewesen. Den operativen Neustart nach der Pleite diktierte der Rotstift: „Leane Struktur ohne Obst und Gemüse, keine bezahlte Werbung, sondern organisches Wachstum, kein Büro, sondern Remote-Only“, summiert Fellmer die harten Schnitte. Statt teurer Bezahldeals stütze man sich heute auf langfristige Partnerschaften.

Der radikale Pivot: Community statt teurer Klicks

Aktuell ist SIRPLUS Teil der neuen YouTube-Show The Green Deal, ein Format, das gezielt die Abkehr vom rein kapitalgetriebenen Skalieren propagiert. Der neue Hebel für SIRPLUS: Reichweite, Community-Building und Creator-Beteiligungen. Die betriebswirtschaftliche Logik dahinter ist zwingend: Wenn hohe Customer Acquisition Costs (CAC) im klassischen Performance-Marketing das ohnehin margenschwache Modell ruinieren, muss die Kundenakquise organisch erfolgen. Durch die enge Bindung an Influencer und eine wertegetriebene Community sollen treue Käufer*innenschichten aufgebaut werden.

Dass dieses Konzept mehr als nur eine Notlösung für fehlendes VC-Geld ist, belegen harte Zahlen. Fellmer beziffert die aktuellen Customer Acquisition Costs stolz auf „unter 5 Euro“. Dieser Wert sei sieben- bis zehnmal besser als noch zu Zeiten von SIRPLUS 1.0. Auf klassische Bezahlkooperationen verzichtet das Start-up mittlerweile völlig; man vergütet rein über Umsatzbeteiligungen oder gespendete Schulmahlzeiten. „Wir suchen weiter nach authentischen Partnerschaften mit Menschen mit Reichweite, die sich für eine Welt einsetzen wollen, in der alle genügend zu essen haben“, skizziert Fellmer sein Anforderungsprofil an Creator. Die Strategie trägt Früchte: Von Q1 2025 auf Q1 2026 verzeichnete das Unternehmen laut Gründer ein Wachstum von 100 Prozent.

Die SIRPLUS-Formel: Drei harte Lektionen für Social Start-ups

Warum widmen wir uns bei StartingUp einem neunjährigen Unternehmen, das streng genommen längst kein Start-up mehr ist? Weil junge Gründer*innen aus exakt dieser Transformation unbezahlbare Lehren für die eigene Frühphase ziehen können:

- Purpose ersetzt keine Unit Economics: Der Fall SIRPLUS demonstriert schonungslos, dass selbst die stärkste gesellschaftliche Mission eine fehlerhafte betriebswirtschaftliche Basis (hohe Logistikkosten bei niedrigen Warenkörben) nicht dauerhaft kompensieren kann. Wer heute ein Social Start-up gründet, muss seine Margen noch rigoroser verteidigen als traditionelle E-Commerce-Modelle.

- Die Grenzen des VC-Modells erkennen: Nicht jedes Geschäftsmodell eignet sich für Venture Capital. Die Entwicklung von SIRPLUS und der aktuelle Motatos-Exit zeigen, dass der Food-Outlet-Markt extrem schwer zu skalieren ist. Junge Start-ups lernen hier, alternative Wachstumswege frühzeitig in Betracht zu ziehen, bevor sie sich in eine gefährliche VC-Abhängigkeit begeben.

- Resilienz als Kernkompetenz: Dass Raphael Fellmer das Tal der Tränen durchschritten hat und sich dem Markt nach einer Insolvenz mit angepasstem Modell neu stellt, ist ein Meisterkurs in Pivotierung und unternehmerischer Widerstandskraft.

Die Konkurrenzsituation hat sich durch den Motatos-Exit nun paradoxerweise entspannt. Ob die Gleichung „Reichweite statt Performance-Marketing“ am Ende aufgeht, wird eine der spannendsten Case Studies der aktuellen Wirtschaftsszene – und ein wertvoller Blueprint für die Start-ups von morgen.

Fellmer selbst zeigt sich für die Zukunft demütig, aber siegessicher. Auf dem Weg zur Profitabilität habe man zwar fast 10 Millionen Euro an Funding benötigt und schmerzhaftes Lehrgeld gezahlt, doch „das Dranbleiben, Neudenken und nicht Aufgeben hat sich gelohnt“. Für 2026 verspricht der Gründer erstmals ein nachhaltig profitables Gesamtjahr. Neben der rein wirtschaftlichen Stabilität hat der passionierte Kämpfer gegen Food Waste inzwischen aber auch einen „ganz profanen“ Meilenstein im Visier: „Für mich persönlich ist dieses Jahr ein echter mehrwöchiger Urlaub nach 14 Jahren des Fast-Durch-Arbeitens ein wichtiges Ziel.“

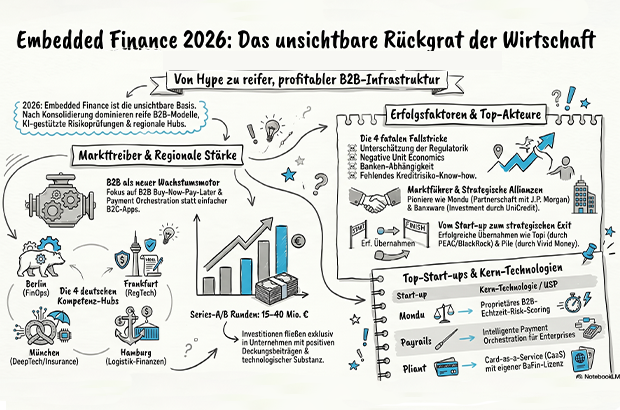

Embedded-Finance-Start-up-Report 2026

Der unsichtbare Bankensektor: Wie Embedded Finance und die dazugehörigen Start-ups die Wirtschaft des Jahres 2026 prägen.

Einst war es das große Versprechen für eine Handvoll hipper Neobanken, heute ist es das unsichtbare Rückgrat der europäischen Wirtschaft: Embedded Finance. Im Jahr 2026 wird das Marktwachstum längst nicht mehr von der fixen Idee isolierter Bank-Apps dominiert, denn jedes zukunftsorientierte Unternehmen ist mittlerweile selbst zu einem/einer Finanzdienstleister*in geworden. Ob Software-as-a-Service-Anbieter*in, Logistik-Plattform oder Marktplatz – die nahtlose Integration von Zahlungen, Krediten und Versicherungen in nicht-finanzielle Kund*innenreisen ist das neue Paradigma.

Dieser Report beleuchtet eine Branche, die den „Sturm der Konsolidierung“ überlebt hat und nun mit reifen Geschäftsmodellen und echten Profiten die Architektur der modernen Wirtschaft neu programmiert.

Vom Hype zur fundamentalen Reife

Nach den massiven Zinsanpassungen und regulatorischen Aufräumarbeiten der Jahre 2023 und 2024 zeichnet der Embedded-Finance-Markt heute ein Bild robuster Reife. Renommierte Analystenhäuser wie Bain & Company und Dealroom haben diese Entwicklung früh vorgezeichnet: Der globale Markt für Embedded-Finance-Dienstleistungen hat sich in ein Multimilliarden-Segment verwandelt, dessen europäisches Transaktionsvolumen mittlerweile signifikante Teile des digitalen B2B- und B2C-Handels stützt. Der technologische Haupttreiber dieser neuen Ära ist unbestreitbar die künstliche Intelligenz, genauer gesagt proprietäre Machine-Learning-Modelle, die Risikobewertungen in Millisekunden durchführen und Transaktionsströme dynamisch optimieren. Investor*innen honorieren diese technologische Tiefe: Wir sehen heute höchst realistische Series-A- und Series-B-Runden im Bereich von 15 bis 40 Millionen Euro für Start-ups, die nachweislich positive Deckungsbeiträge aufweisen. Es fließt wieder signifikant Kapital, doch es fließt exklusiv in Substanz und Skalierbarkeit, nicht mehr in reines Marketing.

Die neuen Treiber: B2B, Vertikalisierung und Orchestrierung

Wenn man über das Offensichtliche wie einfache White-Label-Kreditkarten hinausblickt, dominieren im Jahr 2026 drei spezifische Sub-Sektoren den Markt. Allen voran steht B2B Buy-Now-Pay-Later, eine Disziplin, die das traditionelle, schwerfällige Factoring abgelöst hat und nun direkt in B2B-Checkouts und Beschaffungsnetzwerke integriert ist. Ein weiterer massiver Treiber ist die sogenannte Payment Orchestration für vertikale SaaS-Lösungen. Hier werden komplexe, branchenspezifische Zahlungsflüsse – etwa im Handwerk oder in der Gastronomie – automatisiert im Hintergrund abgewickelt. Zuletzt etabliert sich Embedded Insurance zunehmend im Industriekontext, wo Maschinen nicht mehr nur geleast, sondern im selben Atemzug transaktionsbasiert versichert werden. Pioniere wie die Berliner Mondu oder auch europäische Schwergewichte wie Swan haben den Weg für diese hochspezialisierten Infrastruktur-Layer geebnet und gezeigt, wie tiefgreifend diese Geschäftsmodelle in die Wertschöpfungsketten der Realwirtschaft eingreifen.

Die Lektionen der BaaS-Krise

Doch dieser Reifegrad wurde teuer erkauft. Der Beinahe-Kollaps des britischen Banking-as-a-Service-Pioniers Railsr und die drastischen BaFin-Sonderprüfungen samt Wachstumsbeschränkungen bei etablierten deutschen Playern wie Solaris in den Jahren zuvor haben den Markt fundamental erschüttert. Der Traum, Finanzdienstleistungen wie einfache Legosteine zusammenzustecken, kollidierte brutal mit der harten Realität des Bankwesens.

Aus diesen gescheiterten Hoffnungen lassen sich für heutige Gründer*innen vier konkrete, fatale Fallstricke ableiten. Der erste und wichtigste ist die eklatante Unterschätzung der Regulatorik; Compliance lässt sich nicht auslagern, und Aufsichtsbehörden dulden keine agilen Versuch-und-Irrtum-Prozesse bei der Geldwäscheprävention. Der zweite Fallstrick ist die Falle der negativen Unit Economics im B2C-Sektor, wo exorbitante Kund*innenakquisitionskosten oft nur durch kontinuierliches VC-Geld gedeckt wurden. Drittens das Klumpenrisiko der Abhängigkeit von einer einzigen Partnerbank, deren Ausfall das eigene Start-up über Nacht handlungsunfähig macht. Und viertens die Fehlannahme, dass Technologie allein ausreicht; wer heute kein tiefes Verständnis für klassisches Bilanzstruktur- und Kreditrisikomanagement mitbringt, scheitert unweigerlich.

Das deutsche Netzwerk: Die Schmieden der Infrastruktur

Deutschland hat sich in dieser Konsolidierungsphase als einer der resilientesten Standorte in Europa bewiesen, getragen von vier essenziellen Hubs. Berlin verteidigt dabei seinen Status als unangefochtene Hauptstadt für FinOps und B2B-Zahlungsinfrastruktur, massiv befeuert durch die Talent-Pipelines der TU Berlin sowie das dichte Netzwerk an Serial Entrepreneurs aus der N26- und SumUp-Schule. Frankfurt am Main bildet den unverzichtbaren regulatorischen Gegenpol; hier, im Schatten von EZB und BaFin, entstehen im Umfeld des TechQuartiers und der Frankfurt School of Finance and Management jene Start-ups, die komplexe Compliance- und Treasury-Architekturen für Großbanken bauen. München dominiert den Bereich DeepTech und Embedded Insurance im industriellen B2B-Kontext, was auf die herausragende Stellung des Center for Digital Technology and Management (CDTM) und die enge Verzahnung mit der ansässigen Versicherungs- und Automobilindustrie zurückzuführen ist. Hamburg schließlich hat sich als europäischer Hotspot für Trade Finance und in Logistikketten eingebettete Finanzierungen etabliert, gestützt durch die traditionelle Stärke der Hansestadt im globalen Handel.

Investor*innen-Radar

Das Ökosystem der Geldgeber*innen hat sich im Jahr 2026 stark differenziert und professionalisiert. An der Spitze der spezialisierten VCs agieren Fonds wie FinTech Collective und Motive Ventures (hervorgegangen aus der Übernahme des Berliner VCs embedded/capital), die mit tiefem technologischen Verständnis gezielt in Infrastruktur-Layer investieren. Unter den Top-Tier Generalisten ragen Cherry Ventures, Earlybird und Point Nine heraus, die insbesondere Series-A-Runden bei überzeugenden B2B-SaaS-Modellen anführen.

Ein starker Motor sind zudem Corporate VCs und bankennahe Fonds geworden: CommerzVentures, als unabhängiger Player, treibt Themen wie Climate-Fintech massiv voran, während CVCs der Realwirtschaft wie Allianz X und Porsche Ventures strategisch in Start-ups investieren, die sich nahtlos in ihre eigenen vertikalen Ökosysteme einklinken lassen. In der kritischen Frühphase wird der Markt von einer hochgradig vernetzten Gruppe aus Business Angels angetrieben, die nicht nur erstes Kapital, sondern vor allem regulatorisches Know-how und entscheidende Bankennetzwerke einbringen

Die Top Start-ups (Must-Watch)

Für die nachfolgende Liste der Must-Watch-Unternehmen haben wir strikte Kriterien angelegt. Die Auswahl basiert auf nachgewiesener Marktrelevanz durch echte Kund*innenimplementierungen, einem hohen technologischen Reifegrad und einem diversifizierten Ansatz bei der Lösung komplexer Finanzinfrastrukturprobleme. Zudem war ein nachhaltiges Investoren-Vertrauen in den letzten zwölf Monaten ein Schlüsselfaktor. Wir beleuchten hierbei ausschließlich Start-ups mit Hauptsitz in Deutschland, deren Gründung im Jahr 2020 oder später erfolgte, um die wahre nächste Generation der Branche abzubilden.

Banxware

Das 2020 von Miriam Wohlfarth und Jens Röhrborn gegründete Banxware hat sich als Marktführer für Embedded Lending in Deutschland etabliert. Banxware bietet eine White-Label-Lösung, mit der Marktplätze und Zahlungsdienstleister*innen ihren Händler*innen Sofortkredite basierend auf historischen Umsatzdaten anbieten können. Der USP liegt in der extrem schnellen Risikoprüfung und der nahtlosen API-Integration in bestehende Plattformen. Das enorme Vertrauen der Finanzbranche in dieses Modell spiegelt sich massiv auf Investor*innenseite wider: Neben frühen Leadern wie Element Ventures (heute 13books Capital) ist insbesondere der Einstieg der Großbank UniCredit ein Ritterschlag. Die Bank führte nicht nur die Series-A-Runde an, sondern legte Mitte 2025 mit einem weiteren strategischen Millionen-Investment nach, um die europäische Expansion von Banxware gemeinsam voranzutreiben.

Pliant

Im Jahr 2020 von Malte Rau und Fabian Terner aus der Taufe gehoben, definiert Pliant den Markt für B2B-Kreditkarten und Ausgabenmanagement neu. Das B2B-SaaS-Modell kombiniert eine moderne Karteninfrastruktur mit einer tiefen API-basierten Integration in Buchhaltungs- und ERP-Systeme. Der technologische Vorsprung liegt im eigenen Card-as-a-Service-Angebot (CaaS), das anderen B2B-Plattformen den Launch eigener Kreditkartenprogramme ermöglicht. Ein entscheidender Meilenstein war hierfür der Erhalt der eigenen E-Geld-Lizenz der BaFin, die Pliant die nötige regulatorische Unabhängigkeit verleiht. Unterstützt wird Pliant von namhaften Investoren wie SBI Investment, Alstin Capital – und einem Investment des globalen Schwergewichts PayPal Ventures, das das enorme Skalierungspotenzial der Plattform bestätigt.

Mondu

Die Serial Entrepreneurs Malte Huffmann, Philipp Povel und Gil Danziger gründeten Mondu 2021 und revolutionieren damit den B2B-Zahlungsverkehr. Ihr B2B-BNPL-Modell ermöglicht es Geschäftskund*innen, online wie B2C-Kund*innen auf Rechnung oder in Raten zu kaufen, während der Händler sofort sein Geld erhält. Die Kerntechnologie ist ein proprietäres Echtzeit-Risk-Scoring für Firmenkund*innen. Finanziert wurde diese Vision anfangs von Top-Tier-Fonds wie Valar Ventures und Cherry Ventures. Der ultimative Ritterschlag erfolgte jedoch Ende 2025: Neben dem Erhalt der E-Geld-Lizenz sicherte sich Mondu eine 100-Millionen-Euro-Fazilität von J.P. Morgan Payments inklusive einer strategischen Partnerschaft, um die Buy-Now-Pay-Later-Lösung dem europäischen Kund*innen stamm der US-Großbank anzubieten.

Payrails

Gegründet 2021 von Orkhan Abdullayev, Emre Talay und Nicolas Thouzeau, löst Payrails die Herausforderung der Payment Orchestration. Das FinOps-Start-up baut ein intelligentes Betriebssystem für Zahlungen, das Transaktionen für Enterprise-Kund*innen dynamisch über verschiedene Provider routet, um Kosten zu senken und Autorisierungsraten zu maximieren. Die technologische Brillanz dieser Architektur lockte früh Schwergewichte wie Andreessen Horowitz und EQT Ventures an. Im Sommer 2025 zündete Payrails die nächste Stufe: HV Capital führte eine massive Series-A-Runde über 32 Millionen US-Dollar an, bei der auch alle Top-Tier-Altinvestoren erneut mitzogen, um die globale Expansion der Plattform endgültig zu sichern.

Finmid

Die beiden N26-Alumni Max Schertel und Alexander Talkanitsa starteten Finmid 2021 mit der Mission, jede B2B-Plattform zu einer Finanzierungsquelle zu machen. Ihr Geschäftsmodell fokussiert sich auf Embedded B2B Lending, das speziell auf die Anforderungen von Marktplätzen (wie etwa dem Partner Wolt) zugeschnitten ist – ohne dass diese Plattformen eigenes Kapital bereitstellen oder Risiken tragen müssen. Ihr USP ist die radikale Simplifizierung der B2B-Kreditvergabe durch smarte Echtzeit-Datenverknüpfungen. Angetrieben von einer wuchtigen 23-Millionen-Euro-Series-A-Runde, angeführt vom britischen Fonds Blossom Capital und dem Seed-Lead Earlybird, treibt das Start-up seine aggressive europäische Expansion unaufhaltsam voran.

Topi (Exit)

Charlotte Pallua und Estelle Merle brachten Topi 2021 an den Start, um das Hardware-as-a-Service-Modell in den B2B-Bereich zu integrieren. Über die Plattform können B2B-Kund*innen IT-Equipment flexibel mieten, wobei Topi den gesamten Prozess vom Checkout über das Refinancing bis zum Asset-Management abwickelt. Nachdem Topi mit Händler*innen wie Cyberport massiv skalierte und von Top-VCs wie Index Ventures und Creandum finanziert wurde, erfolgte im Sommer 2025 der strategische Exit: Das FinTech wurde von dem internationalen Leasing-Giganten PEAC Solutions (einem BlackRock-Portfoliounternehmen) übernommen, um das innovative B2B-Mietmodell global in dessen gewaltige Finanzierungsinfrastruktur einzugliedern.

Hakuna

Im Bereich Embedded Insurance schlägt das 2021 von Sebastian Jost, Rupert Mayer und Orhan Köroglu gegründete Hakuna neue Wege ein. Das Start-up bietet Händler*innen eine Plattform für Garantieverlängerungen und Produktschutzversicherungen, nahtlos integriert in den Online- und Offline-Checkout. Der USP ist ein völlig neu gedachtes, digitales Schadensmanagement, das die Abwicklung für Endkund*innen radikal vereinfacht. Finanziert von Top-VCs wie Earlybird und Visionaries Club, hat Hakuna mittlerweile den Sprung ins absolute Enterprise-Segment geschafft: Im Jahr 2025 integrierten Branchenriesen wie Vorwerk, STIHL und Mister Spex die Embedded-Technologie des Start-ups, um ihre eigenen, maßgeschneiderten Produktschutzprogramme europaweit zu skalieren.

Pile (Exit)

Jessica Holzbach startete Pile 2022 und pivotierte das Modell nach dem Krypto-Winter erfolgreich zu einem hochspezialisierten Treasury-Angebot für Start-ups. Die B2B-SaaS-Technologie bündelte Konten und automatisierte die Diversifikation von Einlagen zur Risikominimierung. Das Modell erregte schnell Aufmerksamkeit und führte bereits im Sommer 2024 zu einem frühen Exit: Die 2019 gegründete Berliner Neobank Vivid Money übernahm das Start-up, um das eigene Business-Banking-Angebot mit Piles Treasury-Technologie aufzurüsten – ein Paradebeispiel für die rasante Konsolidierung im FinTech-Infrastrukturmarkt.

Internationaler Ausblick & Fazit

Blickt man über die Grenzen Europas hinaus, formen sich 2026 drei gewaltige Makro-Trends, die den deutschen Markt unausweichlich verändern werden. Aus Asien schwappt die Architektur für grenzüberschreitende Echtzeit-Settlements basierend auf regulierten Stablecoins und digitalen Zentralbankwährungen heran, was das traditionelle Korrespondenzbankensystem massiv unter Druck setzt. Die USA hingegen dominieren die Entwicklung der KI-gesteuerten autonomen Finanzen, bei der das Corporate Treasury von Algorithmen gesteuert wird, die ohne menschliches Zutun Liquidität verschieben. Aus Indien lernen wir, wie Identity-as-a-Service untrennbar mit dem Zahlungsverkehr verschmilzt und Betrug nahezu ausmerzt.

Für Gründer*innen und Investor*innen im DACH-Raum bedeutet dies: Der Fokus muss radikal auf Profitabilität, wasserdichter Compliance und extrem stabiler Infrastruktur liegen. Wer heute in Embedded Finance gewinnt, baut keine bunten Apps mehr, sondern die hochkomplexen, unsichtbaren Stahlträger der digitalen Weltwirtschaft.

Tatendrang trifft Struktur – Ist Deutschland wirklich innovationsmüde?

Gründer*innen haben Gestaltungswillen, aber Bürokratie wirkt als tödliche Handbremse. Im Experten-Interview verrät Zukunftsberater und Start-up-Mentor Dr. Jenkis, was sich jetzt ändern muss.

In der öffentlichen Debatte wird Deutschland oft als Land der Bedenkenträger*innen und der bürokratischen Starre gezeichnet. Doch während die Medien über eine allgemeine Verunsicherung berichten, zeigt ein Blick in die Werkstätten und Büros von Gründer*innen und Unternehmer*innen ein anderes Bild: Hier herrscht „Gestaltungslust“ statt Stillstand.

Eine aktuelle Umfrage der ZUKUNFTSWERKE GmbH mit dem Titel „TATENDRANG TRIFFT STRUKTUR: Innovation im Spannungsfeld zwischen Willen und Wirklichkeit“ räumt mit gängigen Klischees auf. Die Ergebnisse belegen, dass der unternehmerische Kern längst auf Aufbruch programmiert ist: 32 Prozent der Befragten treibt der Wille an, die Zukunft aktiv zu gestalten.

Dr. Dirk Jenkis ist Zukunftsberater und Start-up-Mentor sowie der Kopf hinter ZUKUNFTSWERKE und Experte für die Dynamiken zwischen unternehmerischem Willen und strukturellen Rahmenbedingungen. Warum Innovationen oft auf halber Strecke stecken bleiben und warum das Problem weniger in den Köpfen als in den Strukturen liegt, erklärt er im Interview.

Herr Dr. Jenkis, Ihre Studie zeigt: 32 % der Unternehmer*innen wollen Zukunft aktiv gestalten, statt sie nur zu verwalten. Warum klafft die Schere zwischen diesem inneren Tatendrang und der öffentlichen Wahrnehmung einer „lahmenden Wirtschaft“ so weit auseinander?

Dr. Jenkis: Weil wir zwei völlig unterschiedliche Bilder betrachten. Innen sehe ich Unternehmer mit Energie, Ideen und einem klaren Gestaltungswillen. Außen diskutieren wir oft über Symptome: schwaches Wachstum, zähe Prozesse, Unsicherheit. Das Problem ist nicht fehlender Tatendrang. Das Problem ist, dass dieser Tatendrang in einem Umfeld stattfindet, das ihn oftmals ausbremst. Wenn Sie ständig gegen Bürokratie, langsame Verfahren oder unklare Regeln anlaufen, wirkt selbst die dynamischste Organisation irgendwann träge. Die Wirtschaft ist also nicht lahm. Sie läuft nur oft mit angezogener Handbremse.

Mut (27 %) und Neugier (23 %) sind laut Umfrage die wichtigsten Zutaten für Innovation. Warum ist das „Entscheiden ohne vollständige Datenbasis“ heute die wichtigste Kernkompetenz für Gründende?

Dr. Jenkis: Weil die Welt schneller ist als jede Datengrundlage. Wer wartet, bis alles sicher ist, kommt schlicht zu spät. Gründer bewegen sich immer im Ungewissen. Genau dort entsteht Innovation. Mut heißt nicht Leichtsinn, sondern beschreibt die Fähigkeit, mit Unsicherheit produktiv umzugehen.

Und Neugier sorgt dafür, dass man die richtigen Fragen stellt, statt nur auf Antworten zu warten. Die Kombination aus beidem ist entscheidend: neugierig denken, mutig handeln. Wer das beherrscht, hat einen echten Wettbewerbsvorteil.

Ihre Studie weist darauf hin, dass die gefürchtete Risikoaversion oft bei Kapitalgeber*innen und Investor*innen sitzt. Wie pitcht man als Start-up erfolgreich gegen ein Umfeld an, das zwar Innovation fordert, aber offensichtlich Angst vor dem Scheitern hat?

Dr. Jenkis: Indem man Klarheit schafft. Investoren reagieren nicht auf Vision allein, sondern auf nachvollziehbare Logik. Ein guter Pitch verbindet Mut mit Struktur. Er zeigt: Ich weiß, was ich tue, auch wenn ich nicht alles weiß. Gleichzeitig braucht es auf der Investorenseite mehr Bereitschaft, Risiko als Teil von Innovation zu akzeptieren. Kapitel entscheidet mit darüber, wie viel Innovation möglich wird. Wer nur sichere Wetten eingeht, bekommt keine Durchbrüche.

Die größte Bremse ist nicht der mangelnde Wille, sondern fehlende Ressourcen und regulatorische Hürden. Ist der „Innovationsstandort Deutschland“ also eher ein Sanierungsfall der Strukturen als ein Problem der Köpfe?

Dr. Jenkis: Es ist ganz klar ein Strukturthema. Ich habe in den Antworten dieser Studie sehr viel Energie gesehen. Sehr viel Bereitschaft, Verantwortung zu übernehmen und Neues zu schaffen. Was fehlt, sind oft Geschwindigkeit, Verlässlichkeit und Einfachheit im System. Das Gute daran ist aber: Strukturen lassen sich verändern, wesentlich leichter als Mindset. Und genau darin liegt die Chance. Wir müssen nicht erst Motivation erzeugen. Wir müssen die vorhandene Motivation freisetzen und Gründern mehr Steine aus dem Weg räumen.

15 % der Befragten klagen über zu viele Prozesse und zu wenig Freiheitsgrade. Wie bewahren sich Start-ups beim Wachsen ihre Agilität, ohne in die „Konzern-Falle“ zu tappen?

Dr. Jenkis: Die „Konzern-Falle“ entsteht, wenn Prozesse zum Selbstzweck werden. Wachstum braucht Struktur, aber Struktur muss Klarheit schaffen, statt Tempo zu nehmen. Viele Scale-Ups bauen sich schleichend Komplexität auf, die sie später selbst ausbremst. Entscheidend ist, dass Gründer sich mitentwickeln und ihr eigenes System immer wieder hinterfragen. Ohne Widerspruch entsteht schnell eine Echokammer. Agilität bleibt, wenn jemand regelmäßig stört, Fragen stellt und Entscheidungen schärft. Am Ende gilt: Nicht weniger Prozesse machen agil, sondern die richtigen.

77 % der Befragten haben ihr Geschäftsmodell im letzten Jahr grundlegend hinterfragt. Ist eine permanente „positive Paranoia“ heute die einzige Überlebensstrategie?

Dr. Jenkis: Schon 1996 schrieb der Intel-Mitgründer Andy Groove sein Buch mit dem Titel „Only the Paranoid survive“. Ich würde es eher Wachsamkeit nennen. Erfolgreiche Gründer entwickeln schnell ein feines Gespür dafür, wann sich etwas verändert. Sie hinterfragen sich regelmäßig, ohne sich ständig neu zu erfinden. Das ist ein kontinuierlicher Lernmodus. Wer bestehen will, braucht die Fähigkeit, Stabilität und Bewegung gleichzeitig zu organisieren. Das war schon immer so, ist in der schnelllebigen Wirtschaftswelt von heute aber noch wichtiger.

21 % nutzen bewusst externe Impulse und Netzwerke, um Stillstand zu überwinden. Warum ist das „Schmoren im eigenen Saft“ für junge Unternehmen gefährlicher als jede(r) Wettbewerber*in?

Dr. Jenkis: Weil es die Wahrnehmung verengt. Wenn man nur mit Menschen spricht, die ähnlich denken, entstehen schnell Echokammern. Ideen klingen in der eigenen Blase immer besser, als sie wirklich sind. Risiken werden ausgeblendet, blinde Flecken übersehen. Externe Impulse dagegen bringen Reibung. Und genau diese Reibung sorgt für Klarheit. Wer mit offenen Augen und Ohren durch die Welt geht, sich für Neues begeistert und sich bewusst von anderen – etwa Mentoren oder Sparringspartnern – hinterfragen lässt, entwickelt sich weiter. Wettbewerb fordert von außen. Selbstüberschätzung entsteht von innen.

Im „Museum des Scheiterns“ Ihrer Befragten hängen eher leise Fehlentscheidungen wie unpassende Teams oder kulturelle Blockaden. Was ist die wichtigste Lektion, die Gründende aus diesen strukturellen Fehlern ziehen können?

Dr. Jenkis: Erfolg entscheidet sich selten an der Idee. Vielmehr sind es die Menschen und ihre Art, wie sie zusammenarbeiten. Denn die meisten Probleme entstehen nicht spektakulär, sondern schleichend. Falsche Besetzungen, unklare Kommunikation, fehlendes Vertrauen. Die wichtigste Lektion ist deshalb: Organisation und Kultur sind keine Nebenthemen. Sie sind der Kern unternehmerischen Erfolgs. Darum hier nochmal die klassischen Zitate von Peter Drucker und Safi Bahcall: „Culture eats strategy for breakfast. Structure eats culture for lunch.“

Zum Abschluss: Sie ziehen in Ihrer Studie einen Vergleich zur historischen Fernfahrt von Bertha Benz und sagen: Die Ideen stehen bereit, aber der Weg muss frei werden. Wenn wir dieses Bild auf heute übertragen: Welche eine strukturelle Weiche muss die Politik jetzt stellen, damit die nächste große Idee in Deutschland endlich freie Fahrt bekommt?“