Aktuelle Events

Proxima Fusion: Münchner Start-up sichert sich 7 Mio. für Hochleistungsstellarator

Proxima Fusion, ein Start-up, das Fusionskraftwerke auf der Grundlage des Stellarator-Konzepts entwickelt, hat sein Pre-Seed-Fundraising in Höhe von 7 Millionen Euro abgeschlossen. Den Lead übernahmen die Beteiligungsgesellschaften Plural und UVC Partners, dazu kommen High-Tech Gründerfonds (HTGF) und die Wilbe Group.

Proxima Fusion ist das erste Spin-out aus dem Max-Planck-Institut für Plasmaphysik (IPP): Das Start-up wurde von ehemaligen Wissenschaftlern und Ingenieuren aus dem Max-Planck-IPP, dem MIT und Google-X gegründet. Ziel der Gruppe ist es, in den kommenden Jahren einen neuen Hochleistungsstellarator zu entwickeln. Proxima Fusion plant, dass das erste Fusionskraftwerk auf Basis eines Stellarators in den 2030er Jahren entsteht.

Fusionskraftwerk auf Basis eines Stellarators

Auch Sterne erzeugen Energie durch Fusion. Die am besten erforschte Methode, Fusion auf der Erde zu ermöglichen, ist das Einschließen hochenergetischer, ionisierter Materie, sogenanntes Plasma, in Magnetfeldern. Große Maschinen wie Tokamaks und Stellaratoren nutzen dazu einen donutförmigen, magnetischen “Käfig”. Dazu verwenden Stellaratoren eine Vielzahl komplexer Elektromagneten außerhalb des Plasmas, während Tokamaks einfache, externe Elektromagneten mit einem großen Strom innerhalb des Plasmas kombinieren.

Dadurch ist das Design eines Tokamaks zwar einfacher, aber der große Strom führt zu Schwierigkeiten bei der Stabilitätskontrolle des Plasmas, die beim Stellarator nicht auftreten. Moderne Anlagen mit magnetischem Einschluss können bereits routinemäßig Plasmen mit mehr als 100 Millionen Grad erreichen – das ist in etwa zehnmal so heiß wie das Zentrum unserer Sonne. Die Chance, die Fusion als sichere, saubere und höchst effiziente Energiequelle zu nutzen, motiviert die akademische Forschung seit vielen Jahrzehnten.

Die Arbeiten von Proxima Fusion bauen auf dem Wendelstein 7-X (W7-X) des IPP’s auf, dem mit Abstand fortschrittlichsten Stellarator der Welt. Das Design von Stellaratoren ist zwar deutlich komplexer als von Tokamaks, aber sie bieten entscheidende Vorteile für ein Fusionskraftwerk: Sie können mit weniger operativem Aufwand im stationären Zustand betrieben werden und bieten eine attraktive Lösung für die Bewältigung der Wärmebelastung der Materialoberflächen.

Die ersten Stellaratoren waren noch mit großen Nachteilen behaftet: u.a. schlechter Plasmaeinschluss bei hohen Temperaturen, hohe Verluste an Fusionsprodukten und schwer einhaltbare Konstruktionstoleranzen.

Viele dieser Probleme konnten in den letzten Jahren jedoch gelöst werden: "Die experimentellen Fortschritte von W7-X und die jüngsten Fortschritte bei der Modellierung von Stellaratoren haben das Bild radikal verändert", erklärt Francesco Sciortino, Mitbegründer und CEO von Proxima Fusion. "Stellaratoren können inzwischen die Hauptprobleme von Tokamaks überwinden und signifikant weiterentwickelt werden, wodurch die Stabilität des Plasmas verbessert und stationäre Spitzenleistungen erreicht werden."

Die Leistung von Fusionsanlagen wurde in der Vergangenheit mit dem "Tripelprodukt" aus Dichte, Temperatur und Einschlusszeit quantifiziert. Seit der Inbetriebnahme im Jahr 2015 hat W7-X schnell zu den fortschrittlichsten Tokamaks aufgeholt, die bisher zusammengenommen weitaus mehr Mittel erhalten haben. Allerdings sagt das Tripelprodukt wenig über die technische und wirtschaftliche Tragfähigkeit eines Fusionskonzepts als Grundlage für ein Kraftwerk aus.

W7-X kann auch hier überzeugen: Sein im Februar 2023 erzielter Rekord beim Energieumsatz, d.h. der gesamten Heizleistung multipliziert mit der Dauer des Experiments, ist nur der jüngste Beweis dafür, dass Stellaratoren wie W7-X in einer Reihe wichtiger Aspekte überlegen sind.

Stellaratortechnologie in Deutschland Weltspitze

Jorrit Lion, Mitbegründer und Experte für die Modellierung von Stellarator-Kraftwerken, sagt: "Die deutsche Regierung hat über Jahrzehnte mit visionären Investitionen die Stellaratortechnologie in Deutschland bis zur Weltspitze vorangebracht. Auf dem dadurch geschaffenen Know-how in Instituten und Unternehmen können wir nun als Startup aufbauen. Wir bündeln jetzt diese Expertise um Fusionsenergie aus Stellaratoren ans Netz zu bringen."

Martin Kubie, der nach einem Jahrzehnt Arbeit im Formel-1-Team von McLaren, bei Google-X und dessen Ausgründung Wing zu seinen Mitgründern dazugestoßen ist, ist sich der harten Arbeit bewusst, die vor dem Team liegt: "Die Fusion ist die Herausforderung unserer Zeit. Unsere Aufgabe wird es sein, sie zu einer kommerziellen Realität zu machen. In den nächsten 12 Monaten wird sich Proxima Fusion in Zusammenarbeit mit seinen akademischen und industriellen Partnern auf die Fertigstellung eines ersten Designs für ein Fusionskraftwerk konzentrieren."

Diese Artikel könnten Sie auch interessieren:

Produktivität statt Überstunden: Wie Echtzeitdaten das Finanzwesen von morgen steuern

Das KI-gestützte Fintech Embat beendet das Excel-Chaos im Treasury und macht Finanzteams mit Echtzeitdaten fit für die Zukunft.

Berlin, 28. April 2026 – Es ist ein bekanntes Bild in den Finanz- und Treasury-Abteilungen des deutschen Mittelstands: Wenn der Monatsabschluss naht oder Ad-hoc-Berichte für die Geschäftsführung benötigt werden, bleiben die Schreibtischlampen bis spät in die Nacht an. Die manuelle Zusammenführung von Daten aus unterschiedlichen Bankportalen und historisch gewachsenen Excel-Listen kostet nicht nur Nerven, sondern vor allem wertvolle Zeit.

Das schnell wachsende Fintech Embat tritt an, um genau diesen Engpass aufzulösen. André Reimers, Head of DACH, treibt diese Mission im deutschsprachigen Raum als Gesicht des Unternehmens voran. Seine Kernüberzeugung: Wer heute noch regelmäßig Überstunden machen muss, um finanzielle Transparenz zu schaffen, leidet nicht unter mangelnder Einsatzbereitschaft – er leidet unter einem strukturellen Datenproblem.

Beeindruckendes Wachstum durch das Lösen echter Pain Points

Dass der Schmerz in den Finanzabteilungen groß und der Bedarf an modernen Lösungen riesig ist, belegen die Zahlen, mit denen Embat den europäischen Markt aufrollt. Mit einem starken Kundenwachstum im deutschen Markt von über 250 Prozent im vergangenen Jahr und mittlerweile mehr als 400 mittelständischen und großen Unternehmenskunden weltweit hat sich das Fintech als fester Player etabliert. Das stetig wachsende Transaktionsvolumen von 250 Millionen Euro zeigt deutlich: Der Wechsel von fehleranfälligen Tabellen zu automatisierten Cloud-Lösungen ist in vollem Gange.

Der Weg aus der Excel-Falle

Mit seiner Technologie nimmt Embat den Kampf gegen ineffiziente Prozesse im Treasury auf. Anstatt hochqualifizierte Mitarbeiter mit repetitiver Datenpflege zu binden, automatisiert das System die Konsolidierung aller relevanten Finanzdaten.

„Die Erwartungshaltung, dass komplexe Finanzanalysen zwingend mit langen Abenden im Büro einhergehen müssen, ist schlichtweg nicht mehr zeitgemäß“, erklärt André Reimers. „Wenn Cashflow, Liquidität und Runways per Knopfdruck in Echtzeit abrufbar sind, ändert sich die gesamte Arbeitsdynamik. Finanzteams können aus dem reaktiven Modus heraustreten und sich auf die strategische Steuerung des Unternehmens konzentrieren.“

Hohe Innovationskraft trifft auf lokales DACH-Verständnis

Embat profitiert von einer enormen Innovationsgeschwindigkeit und Agilität, auf der die starke technologische Basis des Unternehmens beruht. Wie diese passgenau auf die spezifischen Bedürfnisse des deutschen Marktes übersetzt wird und für eine hohe lokale Marktpräsenz sorgt, zeigt André Reimers an den Standorten in München und Berlin.

Von diesen beiden Standorten aus steuert André Reimers das DACH-Geschäft und stellt das tiefe Verständnis für die komplexen Strukturen und hohen Sicherheitsbedürfnisse des deutschen Mittelstands sicher. Das Team zeigt dabei, wie moderne, dezentrale Zusammenarbeit erfolgreich funktioniert. Das Vertrauen der stetig wachsenden deutschen Kundenbasis fußt dabei auf dieser geballten lokalen Expertise gepaart mit der unerschütterlichen Zuverlässigkeit der Systeme.

Führen durch Resultate, nicht durch Anwesenheit

Die Botschaft an die Finanzwelt ist klar: Moderne Führung, hohe Produktivität und Skalierbarkeit erfordern keine starren Kontrollmechanismen oder endlosen Arbeitstage. Sie erfordern radikale Datentransparenz und die richtigen digitalen Werkzeuge. Wenn die Daten in Echtzeit fließen, sinkt die Fehlerquote, die Entscheidungsgeschwindigkeit steigt – und die systembedingten Überstunden im Treasury gehören endgültig der Vergangenheit an.

Über Embat:

Embat ist ein KI-gestütztes FinTech mit Schwerpunkt auf Treasury-Management, das es mittelständischen Unternehmen und Großkonzernen ermöglicht, ihre Finanzprozesse in Echtzeit zu zentralisieren. Gegründet von Antonio Berga und Carlos Serrano – ehemaligen J.P. Morgan-Managern mit umfassender Erfahrung im Corporate Banking – sowie Tomás Gil, dem ehemaligen CTO von Fintonic, entstand die Plattform mit der Mission, die Finanzabteilung zu digitalisieren. Die klare Prämisse dabei: Technologie von Finanzexperten für Finanzexperten.

Durch seine hybride Konnektivität lässt sich Embat in über 15.000 Banken und führende ERP-Systeme integrieren und beseitigt so jegliche Datenfragmentierung. Das wichtigste Alleinstellungsmerkmal ist TellMe, ein „Agentic Treasury Analyst“ (autonomer KI-Analyst), der Cashflow-Muster erkennt, komplexe Kontenabstimmungen automatisiert und strategische Entscheidungen zur Optimierung der Liquidität vorschlägt.

Mit Niederlassungen in Madrid, London, Berlin und München definiert Embat die Zukunft des Corporate Finance neu.

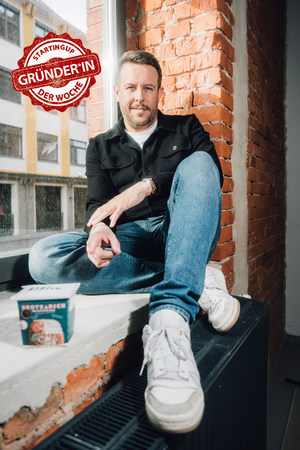

Gründer*in der Woche: Brotrausch – Premium-Teig im recycelten Messbecher

Backen ohne Frust: Wie Brotrausch mit smarten Premium-Mischungen im recycelbaren Messbecher den hart umkämpften DIY-Brotmarkt aufmischen will.

Hinter der 2022 ins Leben gerufenen Marke Brotrausch, die 2023 offiziell an den Start ging, steht heute die Bremer Brot GmbH. Das Unternehmen hat die Marke im Jahr 2025 durch einen Asset Deal übernommen. An der Spitze des Start-ups steht ein Gründer, dessen Wurzeln weit abseits des klassischen Bäckerhandwerks liegen. Philipp Herrnberger, einst in der Sportvermarktung bei Werder Bremen tätig, gründete nicht aus einer entspannten Laune heraus, sondern aus gesundheitlichen Gründen. Nach dem Konsum von herkömmlichem Industrie-Brot kämpfte er immer wieder mit Beschwerden. Sein Antrieb: Ein bekömmliches, transparentes Brot ohne Zusatzstoffe zu kreieren, das man ohne Vorwissen einfach selbst backen kann.

Der Sprung aus der Agenturwelt in die Food-Szene war unkonventionell, doch genau das habe dem Team geholfen, „Dinge anders zu denken“, erinnert sich Herrnberger. In der ersten Phase finanzierte sich das anfänglich fünfköpfige Gesellschafterteam komplett aus eigenen Mitteln. Der Mix aus Bäckermeister, Kaufmann und Kreativen brachte dabei entscheidende Vorteile: „Wir konnten uns voll auf Produkt und Marke konzentrieren, ohne von Anfang an von externen Erwartungen getrieben zu sein“, erklärt der Geschäftsführer. Dennoch räumt er rückblickend offen ein, dass der Bootstrapping-Ansatz an seine Grenzen stieß. „Unter dem Strich muss man sagen, dass wir es ohne externe Investoren nicht geschafft haben“, resümiert Herrnberger über den rettenden Asset-Deal und Neustart im Sommer 2025.

Premium-Teig im recycelten Messbecher

Das Geschäftsmodell hebt sich bewusst vom preissensiblen Massenmarkt ab und richtet sich an all jene, denen im Post-Corona-Alltag schlichtweg die Zeit für aufwändige Sauerteig-Experimente fehlt. Hier setzt das Start-up mit absoluter Convenience an: Die neun natürlichen Brotmischungen erfordern laut Hersteller keinerlei Backerfahrung, kommen gänzlich ohne Küchenmaschine aus und beschränken sich auf rund zehn Minuten aktive Arbeitszeit. Die Zutaten für die „Made in Germany“-Strategie stammen aus kontrolliertem, regionalem Anbau.

Raffiniert und praktisch zugleich ist die Verpackungslösung: Die Mischungen ruhen in einem PET-Becher, der direkt als exakter Messbecher für die benötigte Wasserzugabe dient. Doch gerade ein Plastikbecher weckt in der nachhaltigkeitsgetriebenen Zielgruppe oft Skepsis. Herrnberger verteidigt die Entscheidung leidenschaftlich und verweist auf das rigorose Ausschlussverfahren in der Produktentwicklung. „Kraftpapiertüten sehen offensichtlich nachhaltig aus, wenn sie aber wie für uns beschichtet wären, können sie nur noch verbrannt werden“, kontert der Gründer. Dies sei überhaupt nicht im Sinne der Ressourcenschonung. Stattdessen setzt Brotrausch auf einen vollständig aus recyceltem PET bestehenden Becher einer deutschen Firma. Da die Pappbanderole raffiniert „einschnappt“ und nicht geklebt wird, seien beide Komponenten zu 100 Prozent wiederrecycelbar. Damit sei die Marke auch fit für zukünftige rechtliche Verpackungsvorschriften.

Smarte Nischen und margenstarkes Upselling

Anstatt den oft verlustreichen Preiskampf im regulären Supermarktregal zu suchen, etabliert sich Brotrausch konsequent als D2C-Marke im Premium-Segment. Eine reguläre Brotbackmischung schlägt mit 5,99 Euro zu Buche – eine echte Ansage für ein Produkt, in das die Kundschaft noch Strom, Wasser und Arbeitszeit investieren muss.

„Auf den ersten Blick wirkt der Preis natürlich hoch, vor allem, wenn man ihn rein mit Mehl vergleicht“, gibt Herrnberger zu bedenken. Dieser Vergleich greife jedoch zu kurz. „Wir verkaufen kein Rohprodukt, sondern ein durchdachtes Gesamterlebnis“, betont er und verweist auf die raffinierten Rezepturen und Prozesse, die zu einem Resultat führen, „das viele so zuhause sonst nicht hinbekommen würden“. Die Preisakzeptanz misst das Unternehmen primär über das Feedback und das Kaufverhalten. Als Kund*innen begannen, nicht nur ein zweites Mal zu bestellen, sondern direkt größere Pakete und mehrere Sorten in den Warenkorb legten, wusste das Team: Der Markt akzeptiert den Premium-Aufschlag. Zudem stellt Herrnberger klar: „Im Übrigen kostet das Backen im heimischen und relativ neuen Backofen keine 25 Cent.“

Aus den regulären Supermärkten hat sich Brotrausch mittlerweile bewusst zurückgezogen, da der Kampf um die Regale dort stark über den Preis diktiert wird. „Wir fokussieren uns nun auf Genusspartner wie Weinhändler, Hofläden oder Feinkosthändler, bei denen die Preise hochwertiger Produkte eher akzeptiert werden“, erklärt der Geschäftsführer den strategischen Kurswechsel.

Um die ambitionierte Preisgestaltung zu rechtfertigen, inszeniert das Start-up seine Produkte gezielt als Lifestyle-Upgrade – etwa für das autarke Vanlife beim Camping, als Mitbringsel zum Grillen oder für den Osterbrunch. Flankiert wird das Kernsortiment durch ein lukratives Upselling-Portfolio, das von stilvollen Geschenkboxen für knapp 30 Euro bis hin zu speziellen Baguette-Backblechen, Fruchtaufstrichen und Stullensalzen reicht. Diese Zusatzartikel seien laut Herrnberger zwar nicht essenziell für das Überleben des Unternehmens, da das Brotbacken der Mittelpunkt bleibe, sie seien aber entscheidend für das Wachstum. „Im E-Commerce geht es um den durchschnittlichen Warenkorb und die Retention“, analysiert der Gründer. Das Zusatzsortiment mache das „Erlebnis Brot“ noch intensiver. Der Umsatzanteil dieser lukrativen Extras liegt aktuell bei knapp 15 Prozent.

Die Gretchenfrage der Kund*innenbindung

Dieser strategische Ansatz sichert gesunde Margen und entzieht die Marke geschickt der Vergleichbarkeit mit Discountern. Dennoch bleibt eine große Herausforderung: Der Markt für DIY-Lebensmittel ist durch starke Bio-Traditionsmarken massiv umkämpft. Die größte Hürde besteht darin, die Wiederkaufsrate auf einem profitablen Niveau zu halten. Denn wenn die stylische Mischung primär als originelles Präsent zum Vatertag verschenkt wird, fehlen dem Unternehmen am Ende die wiederkehrenden Alltagsumsätze.

Einen aggressiven Rollout in den stationären Einzelhandel schließt Herrnberger vorerst aus. Dies sei nur mit hohen Investitionen machbar und berge das Risiko, zu einem „One-Hit-Wonder“ zu verkommen. Die Devise lautet stattdessen: „Wir wollen gesund wachsen, um profitabel zu werden.“ Die Geschenkboxen spielen in dieser Strategie eine überraschende Doppelrolle. Sie treffen nicht nur den Zeitgeist, sondern fungieren als cleverer Akquise-Kanal. „Wir erreichen dadurch Menschen, die uns vielleicht noch nicht kennen und unmittelbar mit der Marke, der Qualität und dem Erlebnis in Berührung kommen“, freut sich Herrnberger. Auf diese Weise spare man sich enorme Kund*innenakquisitionskosten. Zudem entwickle sich das Geschenke-Segment zunehmend zu einem echten Profitcenter im B2B-Bereich – etwa wenn Immobilienmakler die Boxen zur Hausübergabe als modernes „Brot und Salz“-Präsent nutzen.

Trotz der starken Nischen-Performance ist klar: Brotrausch muss langfristig beweisen, dass das Premium-Brot aus dem Becher nicht nur an Feiertagen verschenkt wird, sondern den dauerhaften Sprung in die alltägliche Frühstücksroutine der Konsument*innen schafft.

Wie das TechBio-Start-up mbiomics mit 30 Mio. Euro die Krebstherapie skalierbar machen will

Stuhltransplantationen haben gezeigt, dass das Darmmikrobiom ein mächtiger Hebel gegen Krebs sein kann – doch der Ansatz ist bisher kaum standardisierbar. Das Münchner Unternehmen mbiomics setzt auf künstliche Intelligenz und maßgeschneiderte Bakterien-Cocktails aus dem Labor. Mit dem Abschluss einer 30-Millionen-Euro-Serie-A-Runde rückt die klinische Phase näher. Ein genauer Blick auf das Geschäftsmodell, die Gründer*innen und einen hart umkämpften globalen Markt.

Wer heute von modernster Krebstherapie spricht, kommt am menschlichen Darm nicht mehr vorbei. Die wissenschaftliche Datenlage der letzten Jahre hat sich massiv verdichtet: Ob ein Patient auf revolutionäre Krebs-Immuntherapien (wie Immun-Checkpoint-Inhibitoren) anspricht, hängt maßgeblich von der individuellen Zusammensetzung seines Mikrobioms ab. Das Münchner TechBio-Unternehmen mbiomics hat sich genau dieses Zusammenspiel zur Mission gemacht und gab heute den dritten Abschluss seiner Serie-A-Finanzierungsrunde bekannt. Mit neu eingeworbenen 12 Millionen Euro wächst das Gesamtvolumen der Runde auf beachtliche 30 Millionen Euro.

Das Kapital, das unter anderem von erfahrenen Investoren wie den MIG Fonds und Bayern Kapital stammt, markiert für das 2020 gegründete Unternehmen einen entscheidenden Wendepunkt: den Übergang von der reinen Technologieplattform hin zur klinischen Anwendung am Menschen. Der führende Wirkstoffkandidat „MBX-116“ soll 2027 in einer Phase-1B-Studie an Patienten mit fortgeschrittenem schwarzen Hautkrebs (Melanom) getestet werden. Doch wie belastbar ist dieser Ansatz im Vergleich zum Wettbewerb?

Die Köpfe hinter der Vision

Aus der Taufe gehoben wurde mbiomics im Jahr 2020 von Dr. Laura Figulla, Dr. Johannes B. Wöhrstein und Dr. Markus Rinecker. Während die Mitgründer Figulla und Rinecker das Unternehmen in der frühen Phase prägten, wird die nun anstehende Skalierung und klinische Validierung von einem spezialisierten Leadership-Trio gesteuert:

- Dr. Johannes B. Wöhrstein (CEO & Mitgründer): Als technologischer Kopf und Geschäftsführer verantwortet er die firmeneigene Plattform. Seine Expertise in hochauflösender Analytik ist das Fundament, um komplexe mikrobielle Netzwerke mithilfe von maschinellem Lernen (KI/ML) überhaupt erst zu kartieren.

-

Kristin Torre Vinuesa (CFO): Als Chief Financial Officer verantwortet sie die finanziellen Geschicke des Unternehmens. Ihre Rolle ist entscheidend, um die neu eingeworbenen 30 Millionen Euro strategisch einzusetzen, den naturgemäß hohen Kapitalbedarf der anstehenden klinischen Studien („Cash Burn“) effizient zu steuern und das finanzielle Fundament für zukünftige Runden zu sichern.

- Dr. Christopher Weidenmaier (CSO): Der erfahrene Mikrobiologe (zuvor unter anderem beim US-Konkurrenten Finch Therapeutics) komplettiert das heutige Führungstrio. Als Chief Scientific Officer leitet er die präklinische Forschung und treibt das rationale Design der komplexen Bakterien-Konsortien maßgeblich voran.

Das Problem: Die Unberechenbarkeit der Natur

Um das Geschäftsmodell zu verstehen, muss man den Status quo betrachten. In der Onkologie wird aktuell intensiv mit Stuhltransplantationen (Fecal Microbiota Transplants, FMT) experimentiert. Dabei wird das Mikrobiom von Patient*innen, die hervorragend auf Krebsmedikamente ansprechen, auf „Non-Responder“ übertragen. Die Erfolge sind bemerkenswert, doch das Verfahren hat einen massiven Haken: Stuhl ist ein hochvariables Naturprodukt. Er ist schwer zu standardisieren, birgt Infektionsrisiken und lässt sich nicht als skalierbares Pharma-Produkt im industriellen Maßstab herstellen.

Hier setzt mbiomics mit sogenannten Live Biotherapeutic Products (LBPs) an. Statt auf ungefilterte Spender*innen-Transplantate zu setzen, identifiziert das Team mittels KI genau jene Bakterienstämme, die für den therapeutischen Effekt verantwortlich sind. Diese werden dann im Labor nach pharmazeutischen GMP-Standards gezüchtet und als orale Kapsel verabreicht. Es ist der Versuch, die „Blackbox“ Darm in ein berechenbares, patentierbares Medikament zu verwandeln.

Wo liegen die Risiken?

Für Beobachter*innen der Start-up-Szene bleibt das Vorhaben trotz der Millionen-Finanzierung eine Hochrisiko-Wette. Ein TechBio-Start-up in diesem Stadium hat einen enormen „Cash Burn“. Die 30 Millionen Euro sind ein starkes Fundament, doch die klinische Entwicklung in der Onkologie ist ein Langstreckenlauf, der oft dreistellige Millionenbeträge verschlingt.

Zudem ist das Geschäftsmodell hochgradig binär: Die für 2027 geplante Studie muss erst beweisen, dass die im Labor designten Bakterien-Konsortien im komplexen menschlichen Ökosystem tatsächlich die erhoffte Wirkung zeigen. Ein Scheitern des Leitkandidaten MBX-116 könnte das gesamte Vertrauen in die Plattform erschüttern. Zudem ist die Herstellung lebender Bakterien in absolut reproduzierbarer Qualität eine enorme logistische und biotechnologische Herausforderung, an der bereits andere Pioniere der Branche hängen geblieben sind.

Der Markt: Ein globales Rennen

Mbiomics ist nicht allein auf diesem Feld. Das Unternehmen muss sich gegen hochkapitalisierte internationale Konkurrent*innen behaupten:

- MaaT Pharma (Frankreich): Die Franzosen sind klinisch bereits weiter fortgeschritten und setzen auf „Full-Ecosystem“-Produkte aus gepoolten Spenderproben. Mbiomics muss beweisen, dass ihr synthetischer Präzisions-Ansatz dem natürlichen Mix überlegen ist.

- Vedanta Biosciences (USA): Ein US-Schwergewicht, das ebenfalls definierte Bakterienkonsortien entwickelt und bereits über ein breites Netzwerk an Kooperationen mit der Big-Pharma-Industrie verfügt.

Unsere Einordnung

Für das deutsche Ökosystem ist der Erfolg von mbiomics ein Leuchtturm-Signal. Dass Investoren wie MIG – die bereits bei BioNTech ein frühes Gespür bewiesen – hier massiv nachlegen, unterstreicht die Qualität des Standorts München.

Mbiomics wählt den schwierigen, aber potenziell nachhaltigeren Weg. Statt auf die bloße Kopie der Natur zu setzen, versucht das Team, das Mikrobiom durch Daten beherrschbar zu machen. Gelingt der klinische Wirksamkeitsnachweis ab 2027, könnte das Start-up nicht nur die Onkologie verändern, sondern auch Blaupausen für die Behandlung von Autoimmun- und neurodegenerativen Erkrankungen liefern. Der Weg bis dahin bleibt jedoch teuer und wissenschaftlich riskant.

Vom Notfallknopf zum KI-Begleiter: Patronus sammelt 11 Mio. Euro ein

Das 2020 von Ben Staudt und Tim Wagner gegründete Berliner Start-up Patronus sichert sich eine weitere Mio.-Finanzierungsspritze für seinen digitalen (Notruf-)Assistenten im Smartwatch-Format. Doch im stark umkämpften Senior*innen-Tech-Markt reicht ein schickes Design allein nicht mehr aus. Ein Blick hinter die Kulissen von Geschäftsmodell, Historie und wachsendem Wettbewerb.

Die Idee zu Patronus entstand aus einem klassischen Alltagsproblem, das viele Familien kennen: Gründer Ben Staudt erlebte bei seiner eigenen Großmutter, dass der traditionelle, klobige Hausnotrufknopf statt um den Hals zu hängen, lediglich als „Nachttischdekoration“ fungierte. Gemeinsam mit Mitgründer Tim Wagner rief er daraufhin im Jahr 2020 das Unternehmen in Berlin ins Leben. Vor der Veröffentlichung ihres ersten Produkts im Jahr 2021 führte das Team nach eigenen Angaben über tausend Gespräche mit potenziellen Nutzer*innen. Die zentrale Erkenntnis: Die Ablehnung herkömmlicher Notrufsysteme ist weniger technischer Natur, sondern vielmehr ein Problem der Würde und Stigmatisierung.

Mittlerweile ist das Team auf 70 Mitarbeitende angewachsen. Nachdem das Start-up in der Vergangenheit bereits eine beachtliche 27-Millionen-Euro-Runde abschließen konnte, fließen nun weitere 11 Millionen Euro Wachstumskapital in das Unternehmen. Bei dieser Runde wird das Konsortium von 3TS Capital Partners angeführt. Begleitet wird die Finanzierung von Grazia Equity sowie Bestandsinvestoren wie Singular, Burda Principal Investments, Adjacent, NAP und UVC Partners.

Das Produkt: Hohe Akzeptanz trifft auf KI-Visionen

Das Kernprodukt von Patronus ist eine Smartwatch, die sich optisch bewusst von klassischer Medizintechnik abhebt, verschiedene Farben bietet und wie eine herkömmliche Armbanduhr wirkt. Ausgestattet mit einer integrierten SIM-Karte stellt sie im Notfall auf Knopfdruck eine sofortige Verbindung zu einer hauseigenen, mit Fachpersonal besetzten 24/7-Notrufzentrale her.

Der nutzer*innenzentrierte Ansatz zeigt laut Unternehmenszahlen deutliche Wirkung:

- Während klassische Hausnotrufgeräte laut Studien nur von 14 Prozent der Nutzer*innen durchgehend getragen werden.

- Liegt die tägliche Tragequote der Patronus-Uhr bei 85 Prozent.

- Mittlerweile verzeichnet das Start-up 25.000 aktive Kund*innen.

- Die hauseigene Zentrale hat für diese Nutzer*innen bereits mehr als eine halbe Million Notrufe beantwortet.

- Parallel dazu verbindet eine eigens entwickelte App 50.000 Angehörige mit den Senior*innen, um deren Status – wie den Standort oder ob die Uhr getragen wird – im Blick zu behalten.

Das frische Kapital fließt nun in den weiteren Ausbau der Marktführerschaft im mobilen Notrufsegment sowie in einen neuen Produktbereich: einen KI-Begleiter. Dieser soll als digitaler Assistent direkt am Handgelenk über die Patronus Uhr verfügbar sein. Da 12 Prozent der über 75-Jährigen in Deutschland an einem durchschnittlichen Tag kein einziges persönliches Gespräch führen, soll der Assistent dem Gefühl der Einsamkeit in stillen Stunden entgegenwirken.

Geschäftsmodell, Markt & Wettbewerb

So glänzend die Zahlen der Pressemitteilung wirken, verlangt das Geschäftsmodell im dynamischen AgeTech-Sektor eine differenzierte Betrachtung:

Der demografische Rückenwind: Der Bedarf an digitalen Lösungen für ältere Menschen wächst rasant. In Deutschland leben heute 9,6 Millionen Menschen im Alter von über 75 Jahren, in ganz Europa sind es 47,4 Millionen. Gleichzeitig nimmt die Zahl der pflegenden Angehörigen ab. Ein immer größerer Anteil will allein leben. Laut Destatis leben in Deutschland bereits 43 Prozent der Menschen über 75 Jahre allein.

Abo-Modell und Kassen-Abhängigkeit: Patronus refinanziert sich maßgeblich über ein Abo-Modell. Ein wesentlicher Wachstumstreiber ist dabei der deutsche Gesundheitsmarkt: Bei Vorliegen eines Pflegegrads kann die Pflegekasse die monatlichen Nutzungsgebühren (die Software, SIM-Karte und Leitstelle abdecken) stark bezuschussen. Ohne diese staatlichen Subventionen hätten viele Senioren Schwierigkeiten, die fortlaufenden Service-Kosten zu tragen. Diese Abhängigkeit von gesundheitspolitischen Rahmenbedingungen bleibt ein strukturelles Risiko.

Der harte Hardware-Wettbewerb: Patronus positioniert sich als digitaler Marktführer im mobilen Notrufsegment in Deutschland. Doch die Konkurrenz holt auf. Dedizierte Senior*innen-Smartwatches anderer Anbieter*innen bieten ebenfalls moderne Designs, SIM-Karten, Notruf-Sprachverbindungen und teils automatische Sturzerkennungen an. Zudem dringen Tech-Giganten tief in den Markt ein: Apple Watches verfügen längst über präzise Sturzerkennungen und EKG-Funktionen und werden zunehmend von technikaffinen "Best Agern" adaptiert. Der langfristige Burggraben von Patronus muss daher zwingend in der nahtlosen, stark vereinfachten Software-Integration und der menschlichen Notrufzentrale liegen – die Hardware allein ist auf Dauer austauschbar.

Das ethische Dilemma der KI: Einsamkeit unter älteren Menschen ist ein anerkanntes Gesundheitsrisiko, das die kognitive Leistungsfähigkeit beeinflussen, das Demenzrisiko erhöhen und die Lebenserwartung verkürzen kann. Die Lösung von Patronus, diesem Problem mit einem KI-Begleiter zu begegnen, ist innovativ, aber ethisch sensibel. Altersforscher warnen davor, dass "künstliche" Gespräche den Drang nach echten sozialen Interaktionen mindern könnten. Dass Patronus selbst betont, der KI-Begleiter solle menschliche Nähe nicht ersetzen, sondern nur eine Antwort für Stunden bieten, in denen niemand da ist, ist ein wichtiger Disclaimer. Dennoch muss das Unternehmen in der Praxis beweisen, dass die KI im sensiblen Pflegeumfeld echte Empathie simulieren kann, ohne die Nutzer*innen zu verwirren.

Unser Fazit

Patronus zeigt, wie man durch konsequentes User-Centric-Design einen verstaubten Markt aufbricht und stigmatisierte Produkte salonfähig macht. Die neuen 11 Millionen Euro geben dem Start-up den nötigen Spielraum für technologische Innovationen. Um die hohe Bewertung nachhaltig zu rechtfertigen, muss Patronus künftig jedoch beweisen, dass der Vorstoß in die künstliche Intelligenz ethisch sauber umgesetzt wird und man dem zunehmenden Hardware-Preisdruck der Wettbewerber*innen standhalten kann.

Omegga sichert 10 Mio. EUR gegen das Kükentöten

Das 2020 gegründete Münchner Start-up Omegga sichert sich Seed-Kapital für seine optische KI-Spektroskopie. Unsere Marktanalyse.

Omegga wurde 2020 von Katharina Hesseler, Till Nöllgen und Paul Günther gegründet. Zum erweiterten Gründer:innenkreis gehören zudem Moritz Eder, Kyle Hiroyasu und Clara Kaufhold. Das Team bündelt Expertise in den Bereichen KI, Optik und industrielle Systeme. In den vergangenen Jahren entwickelte das Team seine Technologie kontinuierlich vom Prototypen zum Industriestandard weiter und konnte sich bereits 2023 eine Pre-Seed-Finanzierung sowie 2024 Fördermittel des European Innovation Council (EIC) sichern.

CEO und Mitgründerin Katharina Hesseler sieht in dem Einstieg der neuen Partner, die „tiefes technologisches Verständnis mitbringen“, ein „starkes Signal für das enorme Potenzial unseres Ansatzes, einen neuen Standard in der Industrie zu setzen“. Das frische Kapital soll in den gezielten Ausbau des Teams und die kommerzielle Skalierung der Technologie fließen.

Das Problem und die technologische Lösung

Der erste und bereits kommerziell verfügbare Use Case von Omegga widmet sich einem der massivsten ethischen Probleme der modernen Landwirtschaft. Jährlich werden weltweit Milliarden männlicher Küken direkt nach dem Schlüpfen getötet, da sie weder Eier legen noch für die Masthaltung wirtschaftlich nutzbar sind.

Mit der sogenannten spektralen Intelligenz – der Kombination aus KI und Spektroskopie – will Omegga das Unsichtbare sichtbar machen. Im Gegensatz zu vielen Marktbegleitern wählt Omegga einen rein optischen, nicht-invasiven Weg. Durch spezielle Kameras und Lichtfrequenzen werden die Eier im Brutkasten gescannt. Laut eigenen Angaben bietet das Start-up damit die früheste am Markt kommerziell verfügbare Technologie, um das Geschlecht noch vor dem Schlüpfen zu bestimmen. Das System ist bereits bei Kund*innen im laufenden industriellen Produktionsbetrieb im Einsatz.

Markt, Wettbewerb & regulatorischer Druck

Der Markt für das „In-Ovo-Sexing“ wächst rasant, primär getrieben durch den Gesetzgeber. In Deutschland ist das Kükentöten seit 2022 gesetzlich verboten, Frankreich zog nach, und ein EU-weites Verbot wird debattiert. Der Zwang zur Adaption in den Brütereien ist entsprechend hoch.

Omegga tritt in ein Feld ein, das bereits von finanzstarken Konkurrenten besetzt ist:

SELEGGT: Gilt als früher Pionier auf dem Markt. Das Unternehmen nutzt hormonelle Tests am 9. Bruttag, wofür das Ei mittels eines Lasers winzig klein geöffnet werden muss (minimal-invasiv).

In Ovo: Das niederländische Unternehmen setzt auf Flüssigkeitsanalysen mittels Massenspektrometrie am 9. Bruttag und sicherte sich erst kürzlich ein 42-Millionen-Euro-Darlehen der Europäischen Investitionsbank (EIB).

Agri Advanced Technologies (AAT): Die Tochter der EW Group dominiert weite Teile des Marktes mit hyperspektraler Bildgebung, die primär für braune Eier zwischen dem 11. und 13. Tag genutzt wird.

Der entscheidende Vorteil von Omegga: Die Methode kommt völlig ohne Verbrauchsmaterialien wie Chemikalien oder feine Nadeln aus. Da die Eier bei der rein optischen Methode unversehrt bleiben, entfällt das systembedingte Kontaminationsrisiko, das bei invasiven Verfahren entstehen kann.

Unsere Einordnung

Trotz der vielversprechenden Technologie steht Omegga vor Herausforderungen:

Hardware-Skalierung in rauen Umgebungen: Die Systeme müssen in den feuchten, warmen und staubigen Inkubatoren industrieller Brütereien über Jahre hinweg wartungsarm laufen. Hier muss das Start-up beweisen, dass sich die Technologie reibungslos in den globalen Massenbetrieb integrieren lässt.

Der regulatorische „Faktor Zeit“: Rein optische Modelle benötigen oft bis zum 12. Tag für eine verlässliche Auswertung. Sollte die Politik die „Tag 6“-Frist künftig strikt durchsetzen, müssen die KI-Modelle von Omegga beweisen, dass sie derart früh hochpräzise Ergebnisse liefern.

Die Plattform-Vision – Fluch oder Segen?

Omegga positioniert seine Lösung ausdrücklich als Plattformtechnologie für die Landwirtschaft, Lebensmittelproduktion und industrielle Qualitätskontrolle. Wie stark dieses Narrativ bei den Geldgebern verfängt, zeigen die Statements zur aktuellen Runde: Laut Christian Knott (Capnamic) entsteht hier eine Technologie „mit dem Potenzial, gleich mehrere Industrien grundlegend zu verändern“. Auch Mason Sinclair (IQ Capital) lobt die Schaffung einer „Plattform für die nicht-invasive und branchenübergreifende Materialanalyse“.

Dass solche Visionen bei Investor*innen beliebt sind, da sie den adressierbaren Markt massiv vergrößern, ist nachvollziehbar. Für ein 17-köpfiges Start-up birgt die gleichzeitige Erschließung neuer Industriezweige jedoch die Gefahr einer operativen Verzettelung. Der Fokus muss zunächst darauf liegen, den Geflügelmarkt zu durchdringen.

Fazit

Gelingt es Omegga, die rein optische Methode in der Breite zu skalieren und die Genauigkeit auf die allerersten Bruttage zu trainieren, hat das Münchner Start-up einen signifikanten Hebel gegen invasiv arbeitende Wettbewerber. Die 10-Millionen-Euro-Runde ist ein klarer Vertrauensbeweis der Investor*innen in einem schwierigen Funding-Umfeld.

Spritgeld für den Start-up-Motor: PR-Stunt oder genialer Dealflow-Generator? Der neue „GründerTank“ von Christopher Obereder im Check

Reisekosten, Tankrechnungen und Bahntickets sind für junge Bootstrapping-Start-ups oft schmerzhafte Posten. Der Münchner Investor und Ex-Silicon-Valley-Macher Christopher Obereder will mit einer neuen privaten Initiative für Start-ups in Deutschland genau hier ansetzen. Ein Gesamtbudget von bis zu 100.000 Euro steht für betriebliche Mobilitätskosten bereit. Doch hinter der pragmatischen Fördermittel-Story verbirgt sich ein überaus cleveres Geschäftsmodell zur Startup-Akquise. Eine Einordnung.

Wer den GründerTank verstehen will, muss zunächst auf seinen Initiator blicken. Christopher Obereder, in der Szene oft schlicht Startup-Chris genannt, ist kein Unbekannter. Bereits 2017 landete er als 26-Jähriger auf der renommierten „Forbes 30 Under 30“-Liste. Im Silicon Valley erarbeitete er sich einen Ruf als Experte für virales Marketing. Mit Exits und Engagements bei Hit-Apps wie Tellonym baute er sich finanzielles Gewicht auf. Durch medienwirksame Formate, wie die von ihm initiierte Bayern 3 Startup Challenge, brachte er das Thema Start-up-Finanzierung einem breiten Publikum nahe. Heute leitet er von Taufkirchen aus die Start-up-Chris Ventures GmbH und investiert gezielt in junge Tech-Unternehmen.

Spritgeld statt Folien-Bingo

Mit dem GründerTank, der von Unicorn AI unterstützt wird, ruft Obereder nun eine konkrete Mobilitätsförderung ins Leben. Der Fokus liegt dabei nicht auf schönen Präsentationen, sondern auf der harten operativen Realität. Unterstützt werden können je nach Einzelfall unter anderem Kraftstoffkosten für geschäftliche Fahrten, ÖPNV-Tickets, Carsharing oder Reisen zu Messen und Investoren.

Obereders Argumentation ist bestechend pragmatisch: „Wir tanken nicht nur Autos. Wir helfen Gründerinnen und Gründern, in Bewegung zu bleiben“, erklärt der Investor. „Viele Programme sprechen über Innovation. Mich interessiert, ob Gründer wirklich unterwegs sind, Kunden treffen, Feedback einsammeln und Momentum aufbauen. [...] Wenn Bewegung im Alltag ein echter Hebel ist, soll sie nicht an ein paar Rechnungen scheitern.“

Erstes gefördertes Start-up dieser Initiative ist Kluuu, eine innovative Lernplattform, die es Studierenden ermöglicht, ihren Lernstoff in interaktive Quizze umzuwandeln. Deren Vertreter Leon Sean Brown bestätigt den Schmerzpunkt vieler Start-ups: „Die Tankpreise sind hoch, operative Wege kosten Zeit und Geld, und genau dort entsteht oft der nächste Wachstumsschritt.“ Gerade in der frühen Phase zähle jeder Euro.

Der wahre Motor: Dealflow zum Discount-Tarif

Liest man die Ankündigung, wirkt das Projekt sehr wohlwollend. Doch bei genauerer Betrachtung erweist sich der GründerTank als strategisches Meisterstück der Dealflow-Generierung für Obereders Investmentvehikel.

- Geringer Kapitaleinsatz, maximaler Einblick: Die ausgelobten 100.000 Euro sind ein Gesamtbudget. Im Gegenzug für die Chance auf die Übernahme von Zugtickets oder Tankrechnungen reichen unzählige Start-ups ihre Unterlagen und Traktionsdaten ein. Für einen professionellen Investor ist dies ein unschlagbar kostengünstiger Weg, um an hochqualitative, topaktuelle Unternehmensdaten der umtriebigsten Frühphasen-Gründer*innen des Landes zu gelangen. Reguläre Venture-Capital-Fonds geben für das Scouting ein Vielfaches dieses Budgets aus.

- Skalierung durch künstliche Intelligenz: Die Flut an Bewerbungen wird nicht mühsam per Hand sortiert. Die eingereichten Unterlagen werden zunächst KI-gestützt vorbewertet. Die KI dient ausschließlich der Vorbewertung und Priorisierung, bevor am Ende Menschen die finale Auswahl treffen.

- Exzellentes PR-Narrativ: Die Story positioniert Obereder als echten „Hands-on“-Macher und adressiert ein spürbares Problem. Ein Rechtsanspruch auf Teilnahme oder Förderung besteht dabei ausdrücklich nicht, weshalb das finanzielle Risiko für den Initiator absolut gedeckelt ist.

Fazit: Mitfahren, aber smart

Sollten junge Unternehmerinnen und Unternehmer beim GründerTank mitmachen? Die Antwort lautet: Ja, aber mit strategischem Bewusstsein. Für Bootstrapping-Teams bietet das Programm eine unkomplizierte Hilfe. Wer den Zuschlag erhält, gewinnt nicht nur finanzielle Beinfreiheit, sondern landet unweigerlich auf dem Radar eines bestens vernetzten Investors.

Gründer*innen müssen sich jedoch des Tauschgeschäfts bewusst sein: Sie gewähren tiefe Einblicke in ihr Geschäftsmodell, um im Gegenzug potenziell Mobilitätskosten erstattet zu bekommen. Man sollte das Programm daher weniger als reine Spendenaktion betrachten, sondern vielmehr als das, was es im Kern ist: Einer der innovativsten und kosteneffizientesten Start-up-Scouting-Funnel der aktuellen Szene.

11 Mio. USD für VisioLab: Stürzt ein Osnabrücker Start-up die Kassen-Dinos?

Das Start-up VisioLab der Gründer an Tim Niekamp und Iwo Gernemann hat den Kassen-Dinos den Kampf angesagt, in dem es den Checkout in Mensen und Arenen durch simple iPad-KI automatisiert.

In der Systemgastronomie, in Mensen und Stadien ist der größte Engpass oft nicht die Küche, sondern die Kasse. Das Osnabrücker Start-up VisioLab adressiert dieses Problem mit künstlicher Intelligenz und verwandelt handelsübliche iPads in voll funktionsfähige Self-Checkout-Systeme. Für die weitere globale Skalierung hat das Unternehmen nun eine Series-A-Finanzierung in Höhe von 11 Millionen US-Dollar abgeschlossen. Angeführt wird die Runde von eCAPITAL Entrepreneurial Partners und Simon Capital, unterstützt von bestehenden Investor*innen wie dem High-Tech Gründerfonds, APX, dem Family Office zwei.7 und Business Angels wie Jens Ohr. Doch wie robust ist dieses scheinbar simple Geschäftsmodell im hart umkämpften Markt der Kassenautomatisierung wirklich?

Aus der Mensa in die NBA: Die Köpfe hinter dem Kassen-Killer

Gegründet wurde VisioLab im Jahr 2019 in Osnabrück von CEO Tim Niekamp und President & COO Iwo Gernemann. Die Idee entsprang einem stark spürbaren Schmerzpunkt in der Gastronomie: Zur Mittagszeit oder in der Halbzeitpause stauen sich die Gäste, während herkömmliche Kassensysteme oft im fünfstelligen Preisbereich liegen und aufwendig geschultes Personal erfordern. Zudem verschärft der chronische Personalmangel in der Foodservice-Branche die Lage massiv.

Die Vision der Gründer war von Beginn an, den Checkout-Prozess durch KI so drastisch zu vereinfachen, dass die zugrundeliegende Technologie im Betrieb kaum noch als solche wahrgenommen wird. Mit einem aktuellen Team von rund 25 Mitarbeitern an den Standorten Osnabrück und Boston haben Niekamp und Gernemann das System iterativ zur Marktreife geführt und internationalisiert. Das frische Kapital soll nun genutzt werden, um das Team auf etwa 40 Mitarbeiter auszubauen – gezielt verstärkt durch ehemalige Führungskräfte von Klarna, SumUp und Google.

Ein iPad als Kassensystem: Geniestreich oder Achillesferse?

Die technische Umsetzung besticht durch Hardware-Minimalismus. VisioLab eliminiert teure, proprietäre Scanner-Kassen und setzt stattdessen auf ein Apple iPad samt Kamera, kombiniert mit einem kompakten Bluetooth-Bezahlterminal und der eigenen KI-App. Die KI erkennt Speisen und Getränke auf dem Tablett in Echtzeit – unabhängig davon, ob diese verpackt oder lose sind. VisioLab vertreibt dieses Setup als "Plug-and-Play"-Lösung direkt als E-Commerce-Produkt über einen Online-Shop. Ein einziges Foto genügt laut Unternehmensangaben, um der KI ein neues Produkt beizubringen, wodurch das System in weniger als fünf Minuten startklar sein soll.

Die fundamentalen Zahlen belegen, dass diese Strategie derzeit voll aufgeht:

- Transaktionen: Weltweit verarbeiten rund 500 Installationen etwa eine Million Transaktionen im Monat.

- Gesamtvolumen: Das kumulierte Transaktionsvolumen liegt mittlerweile bei knapp 100 Millionen US-Dollar.

- Wirtschaftlichkeit: Im vergangenen Quartal verzeichnete das Unternehmen erstmals einen positiven Cashflow.

Kritisch hinterfragt

Der Verzicht auf stark spezialisierte Hardware ist ein zweischneidiges Schwert. Einerseits ermöglicht es VisioLab eine enorme Vertriebsgeschwindigkeit ohne große Hardware-Vorfinanzierungen und langwierige Installationen. Andererseits ist die rein kamerabasierte 2D-Erkennung auf einem handelsüblichen Tablet potenziell anfällig für komplexe Lichtverhältnisse oder optisch nahezu identische Gerichte. Zudem begibt sich das Start-up in eine absolute Abhängigkeit vom Apple-Ökosystem. Das Geschäftsmodell erfordert eine konstante technologische Weiterentwicklung, um die "Churn-Rate" (Kund*innenabwanderung) gering zu halten, da die Wechselkosten für Gastronom*innen bei einer reinen iPad-Lösung verhältnismäßig niedrig sind.

Der Kampf um die Food-Erkennung

Der globale Markt für "AI Food Recognition" und Self-Checkout erlebt derzeit einen massiven Schub. VisioLab hat sich in diesem Umfeld geschickt in lukrativen, hochfrequentierten Nischen positioniert:

- Sport & Entertainment: In den USA stattet VisioLab beispielsweise die Arena des NBA-Teams Orlando Magic mit 43 Systemen aus und deckt damit fast das gesamte Stadion ab. Weitere Kunden sind die NFL-Teams Atlanta Falcons und Carolina Panthers sowie der Fußballclub Inter Miami.

- Bildung & Corporate: Etwa jeder dritte deutsche Uni-Campus nutzt die Technologie über die Studierendenwerke. Hinzu kommen Betriebskantinen von DAX-Konzernen und Kooperationen mit globalen Caterern wie der Compass Group und Aramark.

Allerdings agiert VisioLab nicht konkurrenzlos. Der Wettbewerb ist technologisch divers und hochkapitalisiert. Das US-Start-up Mashgin gilt als einer der härtesten globalen Konkurrenten. Im Gegensatz zu VisioLab setzt Mashgin auf spezielle Kiosk-Terminals mit multiplen 3D-Kameras. Das erhöht zwar die Hardwarekosten und den Installationsaufwand drastisch, verspricht aber eine extrem hohe Erkennungsgenauigkeit selbst bei chaotischen Objektanordnungen. Auch auf dem Heimatmarkt gibt es mit Start-ups wie auvisus ("VisionCheckout") starke Wettbewerber*innen, die ebenfalls KI-Bilderkennung für Betriebsrestaurants und Kantinen anbieten.

Fazit: Hyperwachstum mit Haken

Für die Start-up-Szene liefert VisioLab ein beeindruckendes Beispiel dafür, wie kluges "Go-to-Market"-Design aussieht. Anstatt den kapitalintensiven Weg proprietärer Hardware-Entwicklung zu gehen, nutzt das Team Standard-Consumer-Hardware und fokussiert die gesamte Wertschöpfung auf die smarte KI-Software am Endgerät.

Diese agile Entscheidung ermöglicht das derzeitige Hyperwachstum: Das US-Geschäft steuert bereits rund 50 Prozent zum Umsatz bei und wächst jährlich um über 1.000 Prozent. Mit dem frischen Kapital, dem Ausbau des US-Standorts durch Co-Founder Iwo Gernemann sowie der gezielten Expansion nach Australien, Neuseeland, Österreich, Großbritannien und in die Niederlande stellt VisioLab die Weichen auf globale Skalierung.

Ob das Osnabrücker Start-up langfristig gegen bestens finanzierte US-Giganten und 3D-Kamera-Spezialisten bestehen kann, wird sich an der Robustheit der Software im massenhaften Dauerbetrieb zeigen. Gelingt es VisioLab, durch kontinuierliches KI-Training seinen Genauigkeits- und "Plug-and-Play"-Vorteil auszubauen, hat das Team hervorragende Chancen, den Checkout-Prozess in der Systemgastronomie dauerhaft zu dominieren.

Schluss mit Kaskodenken: Was der neue Innovationsrat Gründer*innen bringt

Pünktlich zur Hannover Messe formiert sich ein neues Schwergewicht in der deutschen Technologiepolitik: Acht Expertinnen und Experten haben den ehrenamtlichen „Innovationsrat für Deutschland“ ins Leben gerufen. Getragen von der VDI-Initiative „Zukunft Deutschland 2050“ und der Gesellschaft für Informatik (GI) bündelt das Gremium die Stimmen von über 160.000 Ingenieur*innen und Informatiker*innen.

Die Diagnose des Rats fällt drastisch aus: Deutschland verliere im globalen Wettbewerb an Verbindlichkeit und Umsetzungsgeschwindigkeit. Für die Gründer*ionnenszene birgt das Manifest vielversprechende Forderungen – es stellt sich jedoch auch die Frage, ob ein weiteres Gremium die strukturelle Risikoaversion des Standorts durchbrechen kann.

Das Kernproblem: Erfunden in Deutschland, skaliert im Ausland?

Das zentrale Narrativ des Innovationsrats trifft einen wunden Punkt der heimischen Start-up-Ökonomie: Es dürfe nicht länger passieren, dass Schlüsseltechnologien zwar in deutschen Forschungslaboren erfunden, aber aufgrund fehlenden Kapitals oder restriktiver Regulierung im Ausland skaliert werden. Der Rat fordert in seinen „5 Impulsen“ eine fundamentale Neuausrichtung:

- Schluss mit dem Legislaturperioden-Takt: Innovationspolitik muss langfristig und faktenbasiert gedacht werden, nicht in kurzatmigen Wahlzyklen.

- Regulierung als Enabler statt als Bremse: Die Expert*innen fordern den Abbau von europäischem „Goldplating“ (der innovationsfeindlichen Übererfüllung von EU-Normen durch nationale Gesetze) und die Schaffung echter Experimentierräume und Reallabore.

- Mut statt „Kaskodenken“: Anstatt risikoscheu zu agieren, müssen strategische Investitionen in Schlüsseltechnologien fließen. Die Rahmenbedingungen für Scale-ups müssen massiv verbessert werden, um industrielles Skalieren im eigenen Land zu ermöglichen.

Die Köpfe hinter dem Innovationsrat für Deutschland

Die Zusammensetzung des Gremiums unterstreicht den Anspruch, Technologie, Recht und Wirtschaft zusammenzudenken:

- Prof. Dr. Lutz Eckstein: VDI-Präsident und Experte für automatisiertes Fahren an der RWTH Aachen.

- Prof. Dr. Veronika Grimm: Professorin an der TU Nürnberg und als „Wirtschaftsweise“ eine der prägendsten Stimmen der Energiepolitik.

- Prof. Dietmar Harhoff, PhD: Direktor am Max-Planck-Institut für Innovation und Wettbewerb sowie langjähriger EFI-Vorsitzender.

- Prof. Dr. Jürgen Kühling: Regulierungs- und Wettbewerbsexperte sowie ehemaliger Vorsitzender der Monopolkommission.

- Dr. Anne Lamp: Gründerin und Pionierin im Bereich Circular Economy.

- Dr. Melanie Maas-Brunner: Industrielle Forschungsexpertin, ehemalige BASF-Vorständin und designierte Präsidentin des Stifterverbands.

- Adrian Willig: Direktor des VDI mit Fokus auf Ingenieurkompetenzen und Technikstandort-Förderung.

- Prof. Dr. Martin Wolf: Präsident der Gesellschaft für Informatik und Experte für intelligente Produktionssysteme.

Im Start-up-Fokus: Dr. Anne Lamp und der harte Weg der Skalierung

Dass der Innovationsrat nicht nur aus der wissenschaftlichen Helikopterperspektive agiert, zeigt eine entscheidende Personalie: Dr. Anne Lamp sitzt am Tisch. Die CEO und Mitgründerin des Hamburger Start-ups traceless materials steht wie kaum eine andere für die Herausforderungen der industriellen Kreislaufwirtschaft.

Im Jahr 2020 ins Leben gerufen, hat traceless ein vollständig biobasiertes Granulat aus Agrar-Reststoffen entwickelt, das als Alternative zu Plastik dient und unter natürlichen Bedingungen in nur zwei bis neun Wochen kompostierbar ist. Lamp, 2022 mit dem Deutschen Gründerpreis ausgezeichnet und 2025 für den Deutschen Zukunftspreis nominiert, hat ihr Unternehmen erfolgreich aus dem Labor geholt. Mit der Realisierung einer groß angelegten Demonstrationsanlage hat das Start-up das für Hardware-Gründungen berüchtigte „Tal des Todes“ gemeistert. Mit der geplanten Industrieanlage soll die Kapazität künftig um ein Vielfaches gesteigert und das Material massentauglich gemacht werden. Lamps Vita verkörpert exakt das, was der Rat nun auf politischer Ebene einfordert: Die erfolgreiche Überführung nachhaltiger Technologien von der Erfindung in die marktfähige, industrielle Skalierung.

Unsere Einordnung: Ein weiteres Gremium oder echter Hebel?

Die entscheidende Frage für Gründer*innen und Start-ups bleibt: Bewirkt dieser Rat wirklich etwas? An technologiepolitischen Beiräten mangelt es der Bundesrepublik traditionell nicht. So sitzt mit Prof. Dietmar Harhoff bezeichnenderweise der langjährige Vorsitzende der bereits existierenden Expertenkommission Forschung und Innovation (EFI) der Bundesregierung ebenfalls in diesem neuen Gremium.

Dennoch hat der Innovationsrat zwei strategische Vorteile: Er ist explizit unabhängig von Parteien und Einzelinteressen der Wirtschaft und vereint mit dem VDI und der GI die geballte Umsetzungskompetenz der technischen Basis. Die Visionen sind ambitioniert – etwa die Forderung, vertrauenswürdige KI als „Trained in Germany“ zu einem neuen globalen Gütesiegel aufzubauen.

Für Deep-Tech- und Hardware-Start-ups wird der Rat jedoch nicht an der bloßen Anzahl seiner künftigen Stellungnahmen gemessen werden, sondern daran, ob seine Impulse tatsächlich in den Maschinenraum der Politik vordringen. Erst wenn das geforderte Kapital für die Wachstumsphase fließt und Genehmigungsverfahren radikal entschlackt werden, wird das „Kaskodenken“ wirklich der Vergangenheit angehören.

Gründer*in der Woche: Pax Lupus – Mit KI und Drohnen gegen den Wolf

Wolfsbiss in Hamburg: Die Debatte brennt. Das Start-up Pax Lupus von Anna-Karina Katt und Karsten Schmiegel will Herden nun autonom mit KI und Drohnen schützen.

Die Rückkehr des Wolfes nach Deutschland erreicht eine neue Eskalationsstufe: Am 30. März 2026 kam es in einem Einkaufszentrum in Hamburg-Altona zur Bissverletzung einer Frau durch einen Wolf. Es ist der erste Vorfall dieser Art seit der Wiederansiedlung der Tiere vor fast 30 Jahren. Obwohl die betroffene Frau das Universitätsklinikum nach ambulanter Behandlung inzwischen verlassen konnte, ist die Debatte um den Umgang mit dem Raubtier voll entbrannt.

Alexander Bonde, Generalsekretär der Deutschen Bundesstiftung Umwelt (DBU), stellt in diesem Kontext klar: Aus Artenschutzperspektive sei die Rückkehr des Wolfs positiv, doch Wölfe gehören in die Natur und nicht in Städte. Für die freie Natur komme es laut Bonde nun auf wirtschaftliche und praktische Schutzmechanismen an, die ein Nebeneinander von Wild- und Nutztieren ermöglichen. Genau hier setzt das von der DBU mit der „Green Startup“-Förderung unterstützte Unternehmen Pax Lupus an.

Gründer*innen & Vision

Hinter Pax Lupus steht das Gründungsduo Anna-Karina Katt und Karsten Schmiegel. Die beiden haben sich dem Thema Herdenschutz verschrieben und entwickeln ein autonomes System zur nicht-tödlichen Abwehr von Wolfsrudeln. Ihre Motivation speist sich auch aus der Kritik an gängigen Praktiken: Laut Anna-Karina Katt seien etablierte Maßnahmen wie Zäune, Netze und Herdenschutzhunde nicht nur arbeitsintensiv, sondern teils auch umweltschädigend. Besonders die engmaschigen Kunststoffnetze seien kurzlebig und produzierten große Mengen an nicht-recyclebarem Müll. Ein weiteres Problem laut Katt: Andere Wildtiere wie Rehe oder Feldhasen verfangen sich in diesen Netzen, was nicht selten zu schweren Verletzungen oder gar zum Verenden führe.

Das Produkt: Autonome Luftabwehr statt Plastiknetz

Das von Katt und Schmiegel entwickelte Herdenschutzsystem soll völlig netzunabhängig und nach einem mehrstufigen Prinzip auf Basis künstlicher Intelligenz (KI) arbeiten. Für die Überwachung und Sensorik wird in der Mitte der Weide ein Mast aufgestellt, der mit Kameras und Sensoren ausgestattet ist und über Solarmodule mit Strom versorgt wird. Diese Sensoren überwachen Tag und Nacht einen Radius von bis zu 200 Metern und sollen erkennen, wenn sich ein Wolf nähert. Die entwickelte Technik soll dabei zuverlässig Menschen oder andere Tiere von Wölfen unterscheiden, sodass bei harmlosen Weidebesuchern kein Alarm ausgelöst wird.

Wird tatsächlich ein Wolf registriert, eskalieren die Abwehrmaßnahmen schrittweise zur Vergrämung. Aus der Basisstation steigt eine kleine Drohne auf, fliegt das Tier gezielt an und soll es durch entsprechende Manöver vertreiben. Um auch eine Echtzeit-Intervention zu ermöglichen, werden die Schäferinnen und Schäfer bei bestehender Netzabdeckung zeitgleich über den Vorfall alarmiert. Sie können die Lage dann über Kameras zusätzlich einschätzen und die Drohnen-Abwehr bei Bedarf manuell abbrechen. Laut Anna-Karina Katt vertreibt das System Wölfe nicht nur situativ: Durch wiederholte Vergrämung sollen Wölfe lernen, die Weidetiere auch langfristig zu meiden. Dies ermögliche es den Schäfer*innen, lediglich einen einfachen Grundschutz wie Weidezäune aufzustellen.

Geschäftsmodell & Marktanalyse

Pax Lupus bewegt sich in der wachsenden Nische des Agri-Tech und liefert einen innovativen Ansatz für ein hoch emotionales und drängendes Problem in der Landwirtschaft. Beim Vertrieb setzt das Start-up auf den Verkauf sowie das Leasing des Systems und bietet zudem die Übernahme der Wartung an. Die darüber hinaus geplanten „Notfall-Mieten“ bei akuten Wolfsrissen sind strategisch klug positioniert. Damit senkt Pax Lupus die Einstiegshürde für betroffene Schäfer*innen enorm und platziert das Produkt direkt dort, wo der akute Bedarf entsteht.

Der rein deutsche Markt für Wolfsschutz ist trotz stetig wachsender Population zunächst auf klassische Weidebetriebe limitiert. Um als Start-up skalieren zu können, ist die von Pax Lupus geplante Ausweitung auf andere Nutztiere wie Kühe, Pferde oder Hühner entscheidend. Das angedachte KI-Training zur Abwehr von weiteren Raubtieren wie Füchsen oder Kojoten öffnet zudem potenziell die Tür zu internationalen Märkten.

Die stärksten Wettbewerber*innen bleiben vorerst etablierte Zäune und Herdenschutzhunde. Pax Lupus muss beweisen, dass die Gesamtkosten ihres Hightech-Systems für oft margenschwache Weidebetriebe attraktiv sind. Zudem stehen Hardware-Startups immer vor physischen Hürden: Die Solartechnik und Drohnenmechanik müssen auch bei widrigem Wetter fehlerfrei funktionieren.

Fazit

Pax Lupus kombiniert auf clevere Weise Tierschutz mit moderner KI und entlastet Weidetierhalter. Gelingt es dem Startup, die Hardwarekosten wettbewerbsfähig zu halten und die Software zügig auf weitere Raubtierarten auszuweiten, könnte dieses System den Herdenschutz nachhaltig verändern. Letztlich schützt Technologie hier nicht nur das Schaf, sondern hilft laut Anna-Karina Katt auch, artenreiche Offenlandschaften wie Bergweiden, Heide und Deiche als wichtigen Bestandteil Mitteleuropas zu erhalten.

Strategischer Exit: food42morrow übergibt seine Getränkemarke JUMA an die Berentzen-Gruppe

Die Konsolidierung im Markt für funktionale Getränke setzt sich fort: die 2022 gegründete food42morrow GmbH übergibt ihre Marke JUMA im Rahmen eines strategischen Exits an die Vivaris Getränke GmbH & Co. KG, eine Tochtergesellschaft der börsennotierten Berentzen-Gruppe Aktiengesellschaft. Ab Mai 2026 soll die großflächige Skalierung unter der Flagge von Vivaris als JUMA Recharge+ erfolgen.

Die food42morrow GmbH wurde 2022 in Frankfurt am Main mit dem Ziel gegründet, Marktlücken im Bereich Functional Food durch wissenschaftlich fundierte und trendorientierte Konzepte zu schließen. Die Gründer Raoul Kammann, Max Kammann und Carlos Lopez Granado entwickelten mit JUMA eine Antwort auf die steigende Nachfrage nach natürlichen Wachmachern.

Das Kernprodukt RECHARGE+ ist ein teebasierter Hydration Drink, der Elektrolyte, Vitamine und natürliches Koffein (u. a. aus Guayusa) kombiniert. Der Fokus liegt hierbei auf einer Funktionalität ohne Zuckerzusatz, die speziell auf die Bedürfnisse einer urbanen, aktiven Zielgruppe zugeschnitten ist. Bereits 2025 konnte das Start-up die Marktfähigkeit durch erste Listungen im deutschen Lebensmitteleinzelhandel (LEH) nachweisen.

Packaging-Innovation als strategischer Hebel

Ein wesentliches Alleinstellungsmerkmal, das den Exit maßgeblich begünstigt haben dürfte, ist das innovative Gebinde. food42morrow brachte als erstes Unternehmen in Deutschland eine wiederverschließbare Aluminiumflasche mit Schraubverschluss in dieser Kategorie auf den Markt. Diese Verpackung kombiniert die hohe Recyclingquote von Aluminium mit der Flexibilität einer Flasche. Für etablierte Konzerne wie die Berentzen-Gruppe stellt eine solche bereits validierte „Hardware-Innovation“ einen hohen Wert dar, da sie das Risiko bei der Markteinführung neuer Kategorien senkt.

Einordnung: Die „Evolve 2030“-Strategie

Der Zukauf durch die Berentzen-Gruppe ist kein Zufall, sondern Teil einer breiteren Branchenbewegung. Mit der Strategie BERENTZEN EVOLVE 2030 reagiert der Konzern auf den rückläufigen Spirituosenkonsum und investiert massiv in das Segment der alkoholfreien Getränke (AfG). JUMA fungiert hierbei als Portfolio-Ergänzung im margenstarken Premium-Bereich der funktionalen Drinks. Ähnliche Strategien verfolgten zuletzt auch Akteure wie Eckes-Granini oder die Paulaner-Gruppe bei der Integration agiler Innovationsmarken.

Key Learnings für Gründer*innen

Aus dem Case food42morrow lassen sich drei zentrale Erkenntnisse für die Skalierung von Konsumgüter-Start-ups ableiten:

- USP durch Packaging: In einem gesättigten Markt reicht ein guter Inhalt oft nicht aus. Eine technologische oder funktionale Innovation bei der Verpackung kann der entscheidende Türöffner für den LEH und für Akquisitionsgespräche sein.

- Validierung vor Skalierung: Der Exit erfolgte erst, nachdem die Marktfähigkeit (Proof of Market) durch erste Listungen 2025 bewiesen war. Große Player kaufen bevorzugt Marken, die ihre „Kinderkrankheiten“ bereits überwunden haben.

- Positionierung als „Brückenbauer“: food42morrow hat sich erfolgreich als Bindeglied zwischen Start-up-Agilität und industrieller Skalierung positioniert. Dies ermöglicht es den Gründern, sich auf ihre Kernkompetenz – die Produktentwicklung – zu konzentrieren, während die massive Distribution durch die Strukturen eines Konzerns erfolgt.

Was kommt nach JUMA?

Mit der Übergabe der Marke an Vivaris stellt food42morrow seine Kompetenz als Innovationstaktgeber unter Beweis. Bleibt die spannende Frage, welche Trends das Frankfurter Team als Nächstes identifiziert.

meinhaus.digital sammelt eine Mio. Euro für die Sanierungswende ein

Ein „KI-Architekt“, der Renovierungen von Bestandsimmobilien deutlich günstiger und schneller machen soll: Das PropTech meinhaus.digital hat eine Pre-Seed-Finanzierungsrunde in Höhe von einer Million Euro abgeschlossen.

Das von Leonie Dowling, Carolin Krebber und Ina Schröder gegründete PropTech-Start-up meinhaus.digital GmbH mit Sitz in Schwäbisch Gmünd und München hat frisches Kapital in Höhe von einer Million Euro eingesammelt. Angesichts eines Marktes für energetische Gebäudesanierung in Deutschland, in den laut dem Deutschen Institut für Wirtschaftsforschung jährlich über 70 Milliarden Euro fließen, verdeutlicht diese Investition das hohe Interesse an digitalen Lösungen für die Bau- und Immobilienbranche. Getragen wird die Finanzierungsrunde von der L-Bank Baden-Württemberg sowie Business Angels aus Stuttgart und München, zu denen auch der Start-up-Investor Martin Giese gehört.

Der Blick ins Register: Neustart statt Neugründung

Hinter meinhaus.digital stehen die drei Gründerinnen Leonie Dowling, Carolin Krebber und Ina Schröder, wobei Dowling und Krebber als Co-CEOs agieren. Ein Blick ins Handelsregister zeigt: Die rechtliche Keimzelle des Start-ups wurde von Dowling bereits 2021 unter dem Namen Palasts GmbH gegründet. Das Jahr 2025 markiert hingegen den operativen Neustart unter dem heutigen Namen meinhaus.digital sowie die Formierung des aktuellen Gründerinnen-Trios. Ungeachtet dieser Vorgeschichte ist das personelle Wachstum beachtlich. Seit 2025 wuchs das Team von drei auf zwölf Mitarbeiterinnen und Mitarbeiter an. Bis Ende 2026 soll die Belegschaft auf rund 30 Personen aufgestockt werden, wobei der Fokus stark auf den Bereichen Technologie, Vertrieb und Marketing liegt.

KI statt Architekt: Kampfpreis und OBI-Deal

Das Start-up positioniert sich als digitaler Planer für Umbau- und Sanierungsprojekte bei Bestandsimmobilien. Die Plattform kombiniert dafür eine KI-gestützte Software mit dem Fachwissen von echten Architektinnen, Architekten sowie der Energieberatung. Das Ziel ist es, Hauskäufer*innen und Eigentümer*innen eine transparente Maßnahmen-, Kosten- und Finanzierungsplanung aus einer Hand zu liefern. Das Versprechen der Gründerinnen, Planungsleistungen bis zu 70 Prozent günstiger und bis zu zehnmal schneller als klassische Architektenleistungen anzubieten, ist dabei eine klare Kampfansage an die traditionelle Zunft.

Um dieses Modell rasant in den Markt zu drücken, nutzt meinhaus.digital strategische B2B2C-Partnerschaften. Eine Kooperation mit der Baumarktkette OBI läuft bereits und soll die digitale Maßnahmenplanung mit der Umsetzungskompetenz des Marktes verknüpfen. Weitere Pilotprojekte mit Branchengrößen wie Check24, Wüstenrot und Schwäbisch Hall stehen kurz vor dem Roll-out. Damit soll der Kund*innenstamm von aktuell über 100 auf mehr als 4.000 skalieren, um langfristig den Umsatz bis 2027 zu verzehnfachen. Der Bedarf ist da, denn die reale Sanierungsquote hinkt den Klimazielen massiv hinterher, da Planungsleistungen für viele schlichtweg zu aufwendig und zu teuer sind.

Reality-Check: Kommt die Software gegen den Altbau an?

Doch die Vision vom digitalen Architekten muss sich in der harten Realität des deutschen Altbaubestandes erst noch dauerhaft beweisen. Jede Bestandsimmobilie bringt individuelle statische, bauphysikalische und rechtliche Tücken mit sich. Ob die hybride Lösung aus Software und menschlicher Expertise die Nuancen eines verbauten Altbaus lückenlos und fehlerfrei erfassen kann, muss sich in der Praxis zeigen. Auch das Versprechen, signifikant günstiger zu sein, birgt Risiken in puncto Profitabilität. Dies erfordert radikal standardisierte Prozesse im Hintergrund, um als VC-finanziertes Start-up dauerhaft profitable Margen zu erwirtschaften.

Hinzu kommt eine massive Konkurrenz. Der PropTech-Sektor ist heiß umkämpft und gut finanziert. Schwergewichte wie das Berliner Start-up Enter oder Fuchs & Eule positionieren sich bereits extrem stark und mit massivem Werbedruck im Bereich der digitalen Energieberatung, 3D-Modellierung und Fördermittelbeantragung. Das junge Team aus München und Schwäbisch Gmünd muss nun beweisen, dass die architektonische Tiefe ihres Produkts einen echten Burggraben gegenüber der reinen Energieberatung der Wettbewerber bildet.

Fazit: Smartes Playbook, harter Stresstest

Für die Start-up-Community liefert meinhaus.digital ein brillantes Playbook in Sachen Go-to-Market-Strategie. Anstatt das frische Kapital in teures, umkämpftes Endkund*innen-Marketing zu verbrennen, setzt das Team konsequent auf den B2B2C-Kanal. Die Integration in die etablierte Customer Journey von Playern wie OBI oder großen Bausparkassen ist ein top Hebel, um die Kund*innenakquisitionskosten drastisch zu senken und sich Vertrauen bei den Endkund*innen zu leihen.

Gründer*in der Woche: SpeakerMatching.com – Disruption auf der Bühne

Die Eventbranche wächst, doch die Suche nach den passenden Köpfen für die Bühne gleicht oft noch einem analogen Kraftakt. Mit der Plattform SpeakerMatching.com will eine erfahrene Seriengründerin den Spieß nun umdrehen. Es ist ein klassisches Plattform-Play ohne die üblichen Vermittlungsprovisionen – doch kann sich das Modell gegen etablierte Branchengrößen durchsetzen? Wir haben die Gründerin Henriette Hochstein-Frädrich befragt.

Hinter SpeakerMatching.com, im November 2025 als B2B-Marktplatz gelauncht, steht Henriette Hochstein-Frädrich. Sie kennt den Schmerz der Branche nicht nur vom Hörensagen. „Ich kenne den Markt nicht nur als Plattformunternehmerin, sondern auch aus zwei weiteren sehr praktischen Perspektiven: Seit vielen Jahren stehe ich selbst als Speakerin und Moderatorin auf Bühnen, und zugleich habe ich eigene Eventformate und Veranstaltungsreihen im Bereich modernes Female Empowerment konzipiert und umgesetzt“, erinnert sich die Gründerin.

„Gerade als Veranstalterin wurde mir immer wieder bewusst, wie zeitaufwendig, intransparent und teilweise zufallsgetrieben die Suche nach passenden Rednerinnen sein kann“, bringt sie das Kernproblem auf den Punkt. Gleichzeitig habe sie beobachtet, wie sich der Markt zunehmend professionalisiere: „Es gibt mehr Expertinnen, mehr Themen, mehr Formate, aber bislang keine wirklich zeitgemäße digitale Infrastruktur, die Angebot und Nachfrage effizient zusammenführt.“

Dass sie diese Infrastruktur bauen kann, hat sie in der Vergangenheit bewiesen: 2009 gründete sie Pharmatching.com, baute es zur Branchengröße auf und verkaufte es 2017. „Aus meinen früheren Plattformgründungen habe ich vor allem drei zentrale Lektionen mitgenommen: Erfolgreiche Marktplätze lösen ein echtes, konkretes Problem. Vertrauen und Qualität sind im B2B-Umfeld entscheidend. Und nicht zuletzt spielt Timing eine größere Rolle, als viele denken“, betont Hochstein-Frädrich.

Rollentausch statt Kaltakquise

Das Timing sei deshalb ideal, weil Veranstaltende heute Plattformlogiken und Self-Service-Modelle erwarten, wie sie sie aus anderen B2B-Märkten längst kennen. Der Kern von SpeakerMatching.com liegt in der Umkehrung des klassischen Buchungsprozesses. Veranstaltende formulieren ihr Gesuch kostenfrei auf der Plattform, woraufhin sich Speaker*innen direkt bewerben können. Das Start-up finanziert sich stattdessen über Abonnements für die Rednerinnen.

„Uns war von Anfang an wichtig, ein sehr niedrigschwelliges und zugleich faires Preismodell für Speaker*innen zu schaffen“, rechnet die Geschäftsführerin vor. Die monatlichen Mitgliedschaften liegen zwischen rund 59 und 89 Euro. „Wenn über die Plattform ein einzelner Auftrag im mittleren vierstelligen Bereich zustande kommt, hat sich die Investition für viele Redner*innen bereits mehrfach amortisiert.“ Sie stellt aber auch klar: „SpeakerMatching.com ist ein Marktplatz, kein Management- oder Vermittlungsvertrag.“

Doch wie verhindert man eine Flut an unpassenden Bewerbungen? „Die Sorge vor einer unüberschaubaren Bewerbungsflut ist absolut nachvollziehbar, gerade bei offenen Plattformmodellen“, räumt die Gründerin ein. Da Veranstaltende jedoch Parameter wie Budget, Zielgruppe oder Sprache sehr konkret vorgeben, entstehe eine starke Vorfilterung. „Unsere bisherigen Erfahrungen aus den ersten Monaten zeigen sehr deutlich: Unpassende ‚Blindbewerbungen‘ sind die absolute Ausnahme“, versichert Hochstein-Frädrich. Zwar sollen perspektivisch KI-basierte Funktionen eine stärkere Rolle spielen, doch die Vision bleibt menschlich: „Unser Ziel ist daher kein vollständig automatisiertes ‚Black-Box-Matching‘, sondern eine intelligente Plattform, die Entscheidungsprozesse vereinfacht und die Qualität der Interaktionen erhöht.“

Um das Problem des Bypassings – also den Abschluss an der Plattform vorbei – zu umgehen, werden Event-Gesuche zunächst anonymisiert veröffentlicht. „Erst wenn sie passende Bewerbungen erhalten und aktiv in den Austausch gehen möchten, geben sie ihre Identität preis“, erklärt die Gründerin den Prozess. „Wenn Speaker*innen über SpeakerMatching.com kontinuierlich relevante Anfragen erhalten und Veranstaltende effizient passende Expertinnen finden, entsteht eine stabile Win-Win-Dynamik. Genau darauf ist das Modell ausgelegt.“

Markt, Wettbewerb und organisches Wachstum

Der Markt wächst kontinuierlich, wird aber von großen Redneragenturen wie Speakers Excellence oder Premium Speakers dominiert. Diese arbeiten stark kuratiert und rufen oft hohe Vermittlungsprovisionen auf. Um in diesem zweiseitigen Markt das klassische Henne-Ei-Problem zu überwinden, verzichtet die Plattform auf der Veranstaltendenseite auf Gebühren.

Finanziert ist das Vorhaben bisher weitgehend aus eigener Kraft. „Aus meinen früheren Gründungen weiß ich, wie wichtig es gerade in der frühen Phase eines zweiseitigen Marktplatzes ist, Produkt, Zielgruppe und Marktmechanik zunächst sehr präzise zu verstehen und organisch zu entwickeln“, lautet ihr Credo. „Plattformmodelle brauchen Zeit, Vertrauen und kritische Masse, das lässt sich nicht ausschließlich mit Kapital ‚beschleunigen‘, sondern vor allem durch konsequenten Nutzen für beide Marktseiten“.

Dabei grenzt sie sich bewusst von stark kuratierten Agenturen ab. Der Mix aus etablierten Persönlichkeiten und neuen Stimmen sei genau das, was der Markt heute suche. Viele Unternehmen wünschen sich heute bewusst mehr Vielfalt auf ihren Bühnen. „Dabei verstehen wir Diversität nicht nur im klassischen demografischen Sinn, sondern auch als Vielfalt an Perspektiven, Erfahrungen und Denkweisen“, so Hochstein-Frädrich.

Den Vorstoß in Richtung Full-Service-Agenturen samt Ausfallversicherungen bremst sie indes ab. „Im Moment konzentrieren wir uns bewusst darauf, das Matching selbst so gut wie möglich zu machen. Alles Weitere kann – zumindest vorerst – auch von anderen Playern im Ökosystem übernommen werden.“

Fazit

Das Speaker-Business ist traditionell ein echtes People Business. Bei Keynotes für teils fünfstellige Honorare verlassen sich viele Großkund*innen gern auf die persönliche Beratung einer Agentur, die im Krankheitsfall sofort für Ersatz sorgt. Diesen Full-Service kann ein Self-Service-Marktplatz aktuell nur schwer vollumfänglich abbilden.

Dennoch ist SpeakerMatching.com ein mutiger und zeitgemäßer Angriff auf die verkrusteten und provisionsgetriebenen Strukturen der Eventbranche. Gelingt es, rasch eine kritische Masse an hochwertigen Event-Gesuchen zu generieren, hat die Plattform das Potenzial, Angebot und Nachfrage künftig deutlich schneller zusammenzubringen.

Münchner Start-up Isar Aerospace bricht Testflug der „Spectrum“-Rakete aus Sicherheitsgründen ab

Der zweite Testflug der „Spectrum“-Trägerrakete des Münchner Raumfahrtunternehmens Isar Aerospace musste kurz vor der Triebwerkszündung gestoppt werden.

Ursache war nach Unternehmensangaben ein unbefugtes Boot, das in die maritime Sicherheitszone eingedrungen war. Bis das Areal geräumt werden konnte, verstrich das enge Startfenster zwischen 21:00 und 21:15 Uhr. Die Rakete blieb unbeschadet auf der Startrampe.

Sicherheitsmechanismus statt Fehlschlag

In der Raumfahrtbranche wird ein solcher Abbruch (ein sogenannter Scrub) nicht als technologischer Rückschlag gewertet, sondern als Beleg für greifende Sicherheitsmechanismen. Ein erheblicher Unterschied besteht zu einem tatsächlichen Fehlstart, bei dem Hardware verloren geht – wie es beim Erstflug der „Spectrum“ am 30. März 2025 geschah, als die Rakete nach knapp 30 Sekunden wegen eines Ausfalls der Lageregelung ins Meer stürzte.

Da die Rakete dieses Mal keinen technischen Defekt erlitt, werten die Ingenieure den abgebrochenen Countdown als erfolgreichen Härtetest der Bodenanlagen und der automatisierten Betankungsprozesse. Das Team um CEO Daniel Metzler hatte im Vorfeld betont, dass das primäre Ziel der Mission „Onward and Upward“ darin bestehe, kritische Systeme unter operativen Bedingungen zu validieren. Die nun gesammelten Daten fließen direkt in die Vorbereitung des nächsten Versuchs ein.

Die komplexe Logistik eines neuen Startfensters

Wann die „Spectrum“ erneut betankt wird, hängt von einem mehrstufigen Abstimmungsprozess ab. Nach der Sicherung der Rakete muss Isar Aerospace bei den norwegischen Behörden neue Sperrzonen beantragen. Damit Fischer, Frachtschiffe und Fluggesellschaften ihre Routen rechtzeitig anpassen können, müssen offizielle Warnungen für die Schifffahrt (NOTMAR) und den Luftraum (NOTAM) mit entsprechendem Vorlauf herausgegeben werden. Erst wenn diese bürokratischen Hürden genommen sind und Parameter wie das Wetter am Polarkreis übereinstimmen, kann ein neuer Countdown für die Nutzlast – darunter universitäre Kleinsatelliten der TU Berlin, der TU Wien sowie der norwegische FramSat-1 – beginnen.

Warum Andøya? Der strategische Vorteil im hohen Norden

Dass das Münchner Start-up diese logistischen Herausforderungen im hohen Norden auf sich nimmt, anstatt etwa den etablierten europäischen Weltraumbahnhof Kourou in Südamerika zu nutzen, hat strategische und physikalische Gründe.

Die Hauptkunden von Isar Aerospace betreiben kleine Erdbeobachtungssatelliten, die bevorzugt über die Pole fliegen, um die Erdoberfläche lückenlos zu erfassen. Von Andøya aus kann die Rakete auf direktem Weg sicher über das offene Europäische Nordmeer in diesen polaren Orbit starten, ohne Treibstoff für aufwendige Kurskorrekturen zu verbrauchen. Zudem spart der Transport der in Ottobrunn gefertigten Bauteile per LKW und Fähre nach Norwegen wertvolle Zeit und Kosten im Vergleich zu einer Verschiffung nach Französisch-Guayana.

Für Europa bleibt der anstehende Flug der „Spectrum“ ein wichtiges Puzzleteil auf dem Weg zu einem wettbewerbsfähigen, kommerziellen Zugang zum All. Sobald die Sperrzonen vor der norwegischen Küste neu eingerichtet sind, wird sich zeigen, ob das Münchner Unternehmen diese Lücke schließen kann.

Vom Solinger Start-up zum globalen Einhorn: Wie Dash0 die Observability-Giganten dekonstruiert

Das 2023 gegründete KI-Start-up Dash0 hat im März 2026 mit einer 110-Millionen-Dollar-Runde die magische Milliardenbewertung geknackt. Die Vision: Die Systemüberwachung von Software durch offene Standards, radikal faire Preismodelle und pragmatische KI zu revolutionieren. Doch der Frontalangriff auf US-Goliaths wie Datadog birgt strategische Risiken.

In der modernen Softwareentwicklung ertrinken IT-Teams in einer Flut aus Warnmeldungen, Logs und Metriken. Klassische Überwachungs-Tools (Observability) sind oft teuer, komplex und sperren Kunden in geschlossene Daten-Ökosysteme ein. Genau dieses Problem adressiert Dash0 – und hat damit in Rekordzeit Investoren und namhafte Kunden überzeugt. „Systemüberwachung ist heute kaputt: Sie ist zu laut, zu teuer und zu komplex“, bringt es Dash0-CEO und Mitgründer Mirko Novakovic auf den Punkt.

Die Gründer und der rasante Aufstieg zum Einhorn

Hinter Dash0 steht ein Quintett erfahrener Tech-Veteranen. Besonders Mirko Novakovic ist in der B2B-Szene ein Schwergewicht: 2020 verkaufte er sein vorheriges Start-up Instana für rund 500 Millionen US-Dollar an IBM. Dieser „Repeat Founder“-Status erklärt das enorme Vertrauen der Geldgeber.

Die Historie von Dash0 liest sich wie ein Start-up-Märchen im Zeitraffer: Nach der Gründung 2023 im nordrhein-westfälischen Solingen folgte Ende 2024 eine 9,5-Millionen-Dollar-Seed-Runde parallel zum Produktlaunch. Ein Jahr später sammelte das Team 35 Millionen Dollar ein.

Der Ritterschlag folgte nun im März 2026: Mit einer von Balderton Capital angeführten Series-B-Runde über 110 Millionen Dollar steigt Dash0 in den Kreis der Unicorns auf. Diesen Meilenstein verknüpft das Team mit einer klaren Kampfansage: „Mit den 110 Millionen Dollar, die wir heute bekannt geben, bringen wir autonome Abläufe zu jedem Entwicklerteam der Welt – noch bevor unsere Wettbewerber überhaupt begreifen, was mit ihnen geschieht.“

Das Produkt: Ein Frontalangriff auf die Industrie-Norm

Ein Blick unter die Haube zeigt, warum die Plattform so schnell wächst. Das Start-up dekonstruiert gezielt die Schwachstellen der etablierten Milliardenkonzerne:

- Das Ende des „Vendor Lock-ins“: Dash0 basiert vollständig auf offenen CNCF-Standards (OpenTelemetry). Als Abfragesprache wird nativ PromQL genutzt, für Dashboards kommt das quelloffene Perses zum Einsatz. Das bedeutet für Technik-Entscheider: Würde Dash0 die Preise anheben, könnten sie ihre gesamten Dashboards und Alarme einfach mitnehmen und woanders hosten.

- Radikales Pricing: Branchenriesen rechnen oft nach Datenvolumen (Gigabyte) oder Nutzerlizenzen ab, was bei wachsenden Systemen zu explodierenden Budgets führt. Dash0 rechnet rein nach der Anzahl der gesendeten Telemetrie-Datenpunkte ab. Unternehmen können unlimitiert Metadaten anhängen und unbegrenzt viele Entwickler auf das System lassen, ohne dass verdeckte Kosten anfallen.