Aktuelle Events

Gründer der Woche: Beach-Inspector – damit keiner strandet!

Gründer der Woche 31/16

Beach-Inspector ist die weltweit erste umfassende Informations- und Bewertungsplattform für Strände. Über das Konzept und die Köpfe hinter dem Strandbewertungsportal sprechen wir mit Co-Gründer Kai Michael Schäfer.

Welches ist (zurzeit) Ihr persönlicher Lieblingsstrand?

Das wechselt bei mir je nach Stimmung und mit wem ich unterwegs bin. Mein letzter „bester Strandtag“ war am Ses Salines auf Ibiza. Wir waren mit einer größeren Gruppe unterwegs und haben es uns in der Nähe einer coolen Strandbar gemütlich gemacht. Der Strand besticht neben türkisfarbenen Wasser und schöner Natur vor allem durch sein junges und attraktives Publikum. Es kommt immer auf die Situation an.

An welche Strände zieht es uns Deutsche in diesem Sommer am häufigsten und wohin sollte man ggf. daher lieber ausweichen?

Die Klassiker der Deutschen sind nach wie vor Spanien (mit den Balearen und Kanaren), die Türkei und die klassischen Badeziele an der Nord- und Ostsee. Die Türkei hat starke Einbrüche dieses Jahr. Auch nach Ägypten, Tunesien und Marokko zieht es auf Grund der politischen Lage weniger Touristen. Das wiederrum führt zu einem Run auf die klassischen spanischen und italienischen Ziele. Eine sehr gute Ausweichoption ist z.B. die Algarve – hier ist es nicht ganz so voll wie in den klassischen Zielen. Und die Algarve hat Strand-Technisch einiges zu bieten.

Wann und wie sind Sie und Ihre beiden Mitstreiter Thomas Berndorfer und Anton Werner auf die Idee zu Beach-Inspector gekommen?

Ich bin bei einer Urlaubsplanung auf die Idee gekommen. Ich war mit meiner damaligen Freundin bei der Urlaubsplanung. Wie es häufiger ist – sie hatte ganz andere Ansprüche an den Urlaubsstrand, als ich. Beim Recherchieren nach einem passenden Urlaubziel / Urlaubstrand habe ich festgestellt, wie schwierig es ist, verlässliche Strandinformationen zu bekommen. Als ich Anton und Thomas von der Idee erzählt habe, haben wir nach intensiven Vorbereitungen den Entschluss gefasst, Beach-Inspector.com zu gründen.

Was waren die wichtigsten Steps auf dem Weg zum Go live Ihrer Plattform?

Das Stranderhebungsverfahren als solches war anfänglich die größte Herausforderung. Wir mussten ein System entwickeln, mit dem der Strand objektiv und unabhängig von persönlichen Präferenzen erhoben werden kann.

Aktuell haben Sie mehr als 1000 Strände erfasst. Wie finden Sie die zu bewertenden Strände und vor allem: Wer bewertet diese für Sie nach welchen Kriterien?

In der Regel erheben wir Destinationen flächendeckend. Anfänglich haben wir überwiegend mit Praktikanten gearbeitet. Diese wurden eine Woche lang in Berlin eingeschult und trainiert und dann gemeinsam mit einem Teamlead in die zu erhebenden Destinationen entsandt. Mittlerweile kommt überwiegend unser Korrespondenten-Netzwerk zum Einsatz. Das ist ein Netzwerk aus Reisebloggern, Digitalen Nomaden und Langzeitreisenden, die sich von uns als Beach-Inspector Korrespondenten zertifizieren lassen können und dann auf ihren Reisen mit Stranderhebungen Geld verdienen können. Diese Erhebungsmethode macht uns unabhängig von Reise- und Übernachtungskosten. Der Content aus dem Korrespondenten-Netzwerk ist auch qualitativ besser. Dazu kommt, dass diese Erhebungsart viel leichter skalierbar ist.

Wie sieht dann eine Bewertung auf Ihrem Portal konkret aus?

Wir erfassen neben umfangreichen Bild- und Videomaterial über 120 Datenpunkte pro Strand. Von Infrastruktur, über Strand- und Wasserqualität, der Farbe des Sandes, bis zur Bebauung werden alle charakteristischen Eigenschaften des Strandes erhoben. Daneben legen wir sehr viel wert auf Lifestyle-Informationen. Hier beantworten wir Fragen wie z.B. „Welche Nationalitäten sind am Strand?“, „Wie voll ist der Strand belegt über die Saison?“ oder „Warum kommen die meisten Menschen zu diesem Strand (Erholung, Party, Familie, Sport)“?

Alle Faktoren werden hochgerechnet. D.h. wenn man auf Beach-Inspector.com einen Familien-Faktor von 7/10 sieht, dann fließen hier mehr als 10 Unterfaktoren in die Hauptbewertung für Familien ein. Das versetzt uns neben der intensiven Beschreibung und Einordnung aller Punkte in die Lage, einen Strand sehr objektiv zu bewerten.

Mit den Strandbewertungen allein lässt sich wahrscheinlich noch nicht das ganz große Geld verdienen - spannender sind hierfür wohl die Angebote drum herum wie Hotels, Restaurants etc. Was ist hier bereits auf Ihrer Plattform geboten bzw. noch angedacht?

Aktuell verlinken wir an den Stellen, an denen unsere User ihr Erfolgserlebnis haben – also den perfekten Urlaubsstrand gefunden – auf Reiseangebote und Hotels direkt in der Nähe dieses Strandes. Das macht schon jetzt die Urlaubsplanung für unsere User deutlich einfacher. Zukünftig werden wir die Angebote noch besser zum Thema Strand matchen und unser Angebot weiter ausbauen. Das wird u.a. von Flügen, Mietwagen und Ausflugsmöglichkeiten vor Ort bis zur Reservierung der Strandliege mit der Beach-Inspector-App gehen. Es gibt noch zahlreiche Erweiterungsmöglichkeiten, die sowohl auf den Nutzwert, als auch auf Umsatzmöglichkeiten einzahlen.

Gibt es vergleichbare Bewertungsportale? Wenn ja, was machen Sie besser als andere?

Es gibt in fast allen touristisch relevanten Regionen lokale Porte, die eben nur diese eine Destination abdecken. Daneben haben auch Portale wie TripAdvisor oder Holiday-Check Strand-Infos. Der große Unterschied ist, dass wir die Daten strukturiert erfassen und es als einziger Anbieter so möglich machen nach Stränden mit bestimmten Eigenschaften zu filtern und zu suchen. Dazu kommt, dass wir deutlich objektiver informieren können als die lokalen Anbieter.

Bis wann wird man „jeden“ Strand bei Ihnen finden können - gibt’s da schon eine Zielvorgabe?

Dazu kann ich nur sagen: „So schnell wie möglich“. Wir möchten in den nächsten 18 Monaten Europa schon sehr gut abgedeckt haben und auch schon wichtige internationale Ziele auf dem Portal anbieten. Bis jetzt haben wir 20 Destinationen online – auf Deutsch und Englisch. Diesen Sommer erfassen wir unter anderem die Nord- und Ostsee, Kroatien, Sardinien und Zypern.

Und last but not least: Was raten Sie anderen Gründern aus eigener Erfahrung?

Es ist in Berlin nicht leicht, die VC-Branche von einem contentlastigen Business-Modell zu überzeugen. Unsere Erfahrung hat uns gelehrt, dass belastbare KPIs und erste relevante und kontinuierliche Umsätze sehr entscheidend für den Erfolg in der Startphase sind.

Hier geht’s zu Beach-Inspector

Das Interview führte Hans Luthardt

Vorschläge für diese Rubrik an redaktion@starting-up.de

Diese Artikel könnten Sie auch interessieren:

DeepTech trifft Food-Safety: 2,6 Mio. Euro für NanoStruct

Food-Safety-Revolution? NanoStruct weist Bakterien in Stunden statt Tagen nach & holt 2,6 Mio. € Seed-Kapital. Wir machen den DeepTech-Check.

Frische Lebensmittel sind ein Wettlauf gegen die Zeit. Bislang dauert der Nachweis von gefährlichen Erregern wie Salmonellen oder Listerien oft mehrere Tage – ein erhebliches Risiko für verderbliche Waren. Das Würzburger Uni-Spin-off NanoStruct will diesen Engpass mit einer neuen Analyseplattform beheben und hat dafür nun eine Seed-Finanzierung in Höhe von 2,6 Millionen Euro eingesammelt. Doch wie tragfähig ist das DeepTech-Modell in der konservativen Lebensmittelindustrie wirklich?

Das Würzburger Startup NanoStruct tritt an, um die mikrobiologische Lebensmittelanalyse von Grund auf zu beschleunigen. Durch die Kombination von optischer Messtechnik, Nanotechnologie, Biotechnologie und maschineller Datenauswertung soll der Nachweis pathogener Bakterien von mehreren Tagen auf wenige Stunden schrumpfen.

Die aktuelle Seed-Runde über 2,6 Millionen Euro bringt namhafte Investoren an Bord: Angeführt wird die Runde vom High-Tech Gründerfonds (HTGF), Bayern Kapital und dem AUXXO Female Catalyst Fund. Ergänzt wird das Kapital durch drei Business Angels aus dem Netzwerk von BayStartUP.

Gold-Antennen statt Petrischalen

Im Kern basiert das Verfahren von NanoStruct auf der sogenannten Surface-enhanced Raman Spectroscopy (SERS). Die Sensoren nutzen dabei ultrapräzise Gold-Nanoantennen, um selbst geringste Mengen von Bakterien verlässlich zu identifizieren.

Interessant ist hierbei ein Blick auf die technologischen Versprechungen: Während das Startup in jüngsten Einreichungen für Branchenpreise (wie den AMA Innovationspreis 2025) noch explizit von einem "Drei-Minuten-Bakterientest" sprach, stapelt die aktuelle Pressemitteilung etwas tiefer und verspricht eine Verkürzung auf "wenige Stunden". Dies ist ein bekanntes Phänomen in der Bio-Sensorik: Während die reine optische Messung im Labor oft nur Minuten dauert, nimmt die komplexe Probenaufbereitung aus realen, unsauberen Lebensmittelmatrizen in der Praxis weiterhin Stunden in Anspruch. Dennoch: Ein Testergebnis noch am selben Tag ("Same-Day-Detection") bedeutet für Produzenten einen gewaltigen Fortschritt.

Aus dem Uni-Labor zum Millionen-Funding

Die Wurzeln des Unternehmens liegen in der Julius-Maximilians-Universität Würzburg, aus der NanoStruct 2021 ausgegründet wurde. Das Gründerteam vereint dabei interdisziplinäre Kompetenzen:

Dr. Henriette Maaß (CEO) verantwortet die Unternehmensstrategie. Sie führte das Startup bereits erfolgreich durch das EU-Förderprogramm "Women TechEU", welches von Frauen geführte Hochtechnologie-Startups unterstützt.

Enno Schatz (CTO) bringt als Experte für Nano-Optik und Sensorik das tiefe technologische Know-how ein.

Kai Leibfried (CFO) steuert die Finanzierung, Geschäftsentwicklung und die kaufmännischen Prozesse.

Der Weg zur Seed-Runde wurde unter anderem durch BayStartUP geebnet: Bereits 2021 gewann das Team das Finale des Businessplan-Wettbewerbs Nordbayern. Aus diesen ersten Berührungspunkten entwickelte sich laut Carsten Rudolph, Geschäftsführer von BayStartUP, das heutige Investorenkonsortium.

Markt, Geschäftsmodell und Wettbewerb – Eine Einordnung

Mit dem frischen Kapital plant NanoStruct nun die Industrialisierung der Technologie, erste Pilotprojekte mit Kunden sowie den Ausbau des Vertriebs. Langfristig sehen die Investoren das Potenzial der Plattform-Technologie auch in weiteren kritischen Bereichen wie der Wasserversorgung, der Medizintechnik oder der Diagnostik.

StartingUp ordnet das Vorhaben wie folgt ein:

Der Markt (Pro): Das wirtschaftliche Potenzial ist enorm. Erreger-Tests am selben Tag reduzieren Lebensmittelverschwendung drastisch, da verderbliche Waren nicht mehr tagelang in Quarantäne-Lagern auf ihre Freigabe warten müssen. Zudem lassen sich millionenschwere, rufschädigende Rückrufaktionen frühzeitig abwenden.

Markteintrittsbarrieren (Contra): Die Lebensmittelindustrie ist hochgradig konservativ und streng reguliert. Ein neues Testverfahren muss nicht nur schneller, sondern zu 100 Prozent fehlerfrei arbeiten. "False-Positives" (falscher Alarm) kosten die Industrie Geld, "False-Negatives" gefährden Menschenleben. Das Vertrauen der Industrie in etablierte Standardverfahren ist historisch gewachsen und tief verankert.

Hardware-Skalierung: Im Gegensatz zu reinen Software-Geschäftsmodellen muss NanoStruct die SERS-Sensoren auf Nanotechnologie-Basis wirtschaftlich in Masse herstellbar machen. Die Skalierung von DeepTech-Hardware verschlingt erfahrungsgemäß viel Zeit und hohe Folgeinvestitionen.

Der Wettbewerb: NanoStruct tritt gegen milliardenschwere Diagnostik-Konzerne und etablierte Verfahren wie PCR-Tests an. Der entscheidende USP von NanoStruct wird es sein, zu beweisen, dass die Sensoren in der rauen industriellen Praxis tatsächlich so robust, günstig und verlässlich sind, dass sie die immensen Wechselkosten für Großkunden rechtfertigen.

Fazit

NanoStruct bringt technologisch exzellente Voraussetzungen mit und hat sich mit dem HTGF, Bayern Kapital und AUXXO sehr starke, gut vernetzte Partner gesichert. Gelingt es dem Team nun, die Technologie aus dem Würzburger Labor erfolgreich in die industrielle Realität der Lebensmittelproduktion zu übertragen, könnte das Startup tatsächlich einen neuen Goldstandard in der mikrobiologischen Qualitätskontrolle etablieren. Die wichtigste Phase – der Beweis am Kunden – beginnt jetzt.

Primogene: 4,1 Mio. Euro für den Muttermilch-Code – Deep-Tech-Innovation oder riskantes Unterfangen?

Das Leipziger BioTech-Start-up Primogene hat eine Seed-Finanzierung in Höhe von 4,1 Mio. Euro eingesammelt, um komplexe bioaktive Moleküle im industriellen Maßstab auf den Markt zu bringen.

Während die Unternehmenskommunikation den Durchbruch einer neuen Plattformtechnologie feiert, zeigt ein genauerer Blick auf den globalen Markt für humane Milcholigosaccharide (HMOs) ein Haifischbecken voller multinationaler Konzerne. Eine kritische Analyse des Geschäftsmodells, der Gründer*innen und des Wettbewerbs.

DeepTech Made in Leipzig

Hinter Primogene stehen Dr.-Ing. Reza Mahour (CEO), Valerian Grote und Linda Karger (COO), die das Unternehmen 2023 in Leipzig gründeten. Die Zusammensetzung des Teams vereint technologische und wissenschaftliche Expertise, um die ehrgeizige Vision einer industriellen Enzym-Produktion umzusetzen. Die aktuelle, 4,1 Millionen Euro starke Seed-Runde wird vom High-Tech Gründerfonds (HTGF) angeführt. Zum Investoren-Konsortium gehören außerdem der Technologiegründerfonds Sachsen (TGFS), better ventures, die Sächsische Beteiligungsgesellschaft (SBG), die Golzern Holding GmbH, die FS Life Science Investment GmbH sowie Dr. Marc Struhalla, Gründer und CEO der c-LEcta GmbH. Der Kapitaleinsatz ist klar definiert: Die neuen Mittel fließen in den Ausbau des IP-Portfolios, die Erweiterung der Produktionskapazitäten in Leipzig und in strategische Partnerschaften.

Das Modell im Stresstest: Die Kostenfalle der Enzyme

Primogene hat eine enzymatische Plattformtechnologie entwickelt, um Inhaltsstoffe zu produzieren, die identisch zu natürlichen Molekülen sind – nachhaltig und kosteneffizient. Im Zentrum stehen dabei komplexe humane Milcholigosaccharide (HMOs) wie Disialyllacto-N-Tetraose (DSLNT) und Difucosyllacto-N-Tetraose I (LNDFH I). Laut Primogene verursachen etablierte fermentative Herstellungsverfahren erhebliche Kosten und stoßen bei der Produktion derartiger hochkomplexer Moleküle an ihre Grenzen.

Der Lackmustest: Die Prämisse, dass enzymatische Verfahren in der Massenproduktion überlegen sind, birgt in der Praxis massive Hürden. Die Entwicklung und wirtschaftliche Produktion der benötigten Enzyme selbst ist extrem kapitalintensiv. Dass das Start-up den gesamten Prozess – von der Enzymentwicklung über die Produktion und Biotransformation bis zur Aufreinigung – komplett am eigenen Unternehmensstandort in Leipzig abbilden will, ist ein ambitionierter, aber riskanter Schritt. Der Aufbau eigener Produktionsanlagen für komplexe BioTech-Prozesse führt oft zu einer enorm hohen Kapitalverbrennungsrate (Burn Rate).

Erste kommerzielle Meilensteine dämpfen dieses Risiko jedoch: Erste Inhaltsstoffe für Kosmetikprodukte wurden mit Kooperationspartnern entwickelt und sind bereits kommerziell erhältlich. Auch pharmazeutische Rohstoffe befinden sich aktuell im Test bei Kund*innen. Zudem erforscht das Unternehmen in Zusammenarbeit mit dem Fraunhofer-Institut für Zelltherapie und Immunologie (IZI) in Leipzig das Potenzial seiner Inhaltsstoffe zur Prävention von Infektionskrankheiten.

Im Haifischbecken: Auf Kollisionskurs mit den Lebensmittel-Riesen

Der Zielmarkt ist hochattraktiv: Der globale HMO-Markt wächst jährlich um etwa 18 bis 20 Prozent, und über 65 Prozent der im Jahr 2023 neu eingeführten Säuglingsnahrungsprodukte enthielten mindestens ein HMO. Neben der Säuglingsernährung bedient Primogene auch Märkte wie die Darmgesundheit bei Erwachsenen, die Gedächtnisverbesserung im Alter sowie funktionale Inhaltsstoffe für Körperpflege und pharmazeutische Rohstoffe.

Das Leipziger Team trifft in der Nahrungsmittelindustrie jedoch auf einen extrem konsolidierten Markt, der von Milliarden-Konzernen dominiert wird. Einer der größten B2B-Zulieferer für Säuglingsnahrung weltweit ist DSM-Firmenich (mit der übernommenen Sparte Glycom), der den Markt durch gigantische Größenvorteile (Economies of Scale) in der Fermentation beherrscht. Auch Chr. Hansen (Jennewein), ein Pionier in der mikrobiellen HMO-Synthese, stellt mit seiner extrem tiefen Integration bei Lebensmittelriesen einen massiven Konkurrenten dar. Auf der Abnehmerseite agieren Endkonsument*innen-Giganten und Branchenführer wie Nestlé und Abbott, bei denen für einen neuen Zulieferer von Inhaltsstoffen extrem hohe regulatorische und volumenbasierte Hürden bestehen.

Primogenes strategische Nische: Ein Preiskampf bei einfach strukturierten Standard-HMOs gegen die großen Fermentations-Player wäre für ein Start-up kaum zu gewinnen. Primogenes entscheidender Wettbewerbsvorteil liegt jedoch in der Komplexität. Die industrielle Produktion von Molekülen wie DSLNT – das laut klinischen Studien signifikante gesundheitliche Vorteile speziell für Frühgeborene bietet – war bislang schlicht nicht möglich. Wenn Primogene hier durch sein starkes Patentportfolio die technologische Lücke schließt, umgeht das Unternehmen den harten Konkurrenzkampf im Massenmarkt.

Unser Fazit: Hohes Risiko, riesiger Hebel

Primogene ist kein schlankes Software-Projekt, sondern waschechtes DeepTech. Das bedeutet: Hohe regulatorische Hürden, langer Atem in der Forschung und massive Kapitalanforderungen. Die Seed-Finanzierung in Höhe von 4,1 Millionen Euro ist ein starker Vertrauensbeweis erfahrener Investoren, wird für den Anlagenbau und die Skalierung der Leipziger Produktion auf Dauer jedoch kaum ausreichen. Primogene muss nun rasch beweisen, dass die enzymatische Synthese nicht nur technologisch überlegen, sondern auch unter realen industriellen Kostendrücken skalierbar ist. Gelingt dieser Proof of Concept, hält das Start-up den Schlüssel zu einer neuen Generation komplexer, bioaktiver Moleküle in der Hand.

110-Mio.-Dollar-Turbo: Sereact verpasst Robotern eine Vorstellungskraft

Mit 110 Mio. Dollar frischem Kapital und „Cortex 2“ greift das Stuttgarter Start-up Sereact die USA an. Die Vision: Roboter, die physikalisch mitdenken, statt nur blind zuzugreifen.

Das 2021 gegründete Stuttgarter Start-up Sereact hat in einer aktuellen Serie-B-Finanzierungsrunde 110 Millionen US-Dollar eingesammelt. Mit dem Versprechen, Industrierobotern durch sogenannte „Weltmodelle“ eine Art situative Vorstellungskraft zu verleihen, zieht das Unternehmen erneut internationale Schwergewichte an. Doch während die Kriegskasse für die anstehende US-Expansion prall gefüllt ist, stellt sich die Frage: Kann der datengetriebene Ansatz aus dem Schwabenland die hochfinanzierte US-Konkurrenz auf ihrem Heimatmarkt wirklich ausstechen? Eine Analyse.

Millionen-Spritze für den Weltmarkt

Die Gründungsgeschichte von Sereact liest sich wie ein europäischer Tech-Traum. Ralf Gulde (CEO) und Marc Tuscher (CTO) starteten 2021 als Ausgründung der Universität Stuttgart. Was mit improvisierten Servern aus gebrauchten Grafikkarten begann, hat sich zu einem globalen Geschäft entwickelt: Nach einer Serie-A-Runde im Jahr 2025 führt nun der VC Headline die 110-Millionen-Dollar-Runde an. Beteiligt sind zudem Bullhound Capital, Daphni und Felix Capital, womit das Gesamtkapital auf über 140 Millionen US-Dollar steigt.

Der Grund für das massive Interesse liegt in der Skalierbarkeit: Mit über 200 europaweit eingesetzten Systemen gilt Sereact als einer der am häufigsten eingesetzten Anbieter von KI-Kommissionierrobotern. Die Kundenliste umfasst Größen wie BMW, Mercedes-Benz, DHL, PepsiCo und die Österreichische Post.

Cortex 2: Denken vor dem Greifen

Bisher basierte der Erfolg auf der Koppelung von Sprachmodellen und Bilderkennung. Mit der neuen Generation „Cortex 2“ geht Sereact einen Schritt weiter: Das System erweitert ein Vision-Language-Action-Modell (VLA) um ein „Weltmodell“. Anstatt nur zu reagieren, gleicht die KI Aktionen mit einem erlernten Modell der Physik ab und wählt den vielversprechendsten Weg aus.

Dieser Wechsel vom Reagieren zum Schlussfolgern ermöglicht komplexe Aufgaben, bei denen feinfühliger Kontakt entscheidend ist – etwa das Zusammenbauen von Komponenten unter Spannung oder das kratzerfreie Anbringen eines Scheibenwischers. CTO Marc Tuscher betont: „Wir bauen keine Roboter. [...] Die Hardware wird zur Massenware. Das Modell nicht.“

Der Eine-Milliarde-Picks-Vorsprung

Sereact positioniert sich als reines Software-Unternehmen, sieht seinen entscheidenden Vorteil jedoch in der Datenqualität. Ein kritischer Blick auf den Markt zeigt:

- Reale Daten vs. Simulation: Während viele Wettbewerber mit simulierten Daten trainieren, wurde Cortex 2 auf Basis von mehr als einer Milliarde realer Greifvorgänge aus der Produktion entwickelt.

- Nachgewiesene Präzision: Sereact begegnet der Skepsis gegenüber KI in der Logistik mit harten Zahlen. Laut Unternehmen erfordert nur noch jeder 53.000. Kommissioniervorgang ein menschliches Eingreifen.

- Hardware-Abhängigkeit: Trotz der Software-Stärke bleibt Sereact darauf angewiesen, dass Kunden in moderne Roboterarme und Sensorsysteme wie die hauseigene „Sereact Lens“ investieren.

Showdown in den USA

Mit der Präsentation auf der MODEX in Atlanta und der geplanten Eröffnung eines Büros in Boston in diesem Sommer bläst Sereact zum Angriff auf den US-Markt. Amerikanische Hersteller fordern produktreife KI, die sofort einsatzbereit ist.

Für die Gründer*innenszene sendet Sereact ein klares Signal: Der nächste Paradigmenwechsel der KI findet in der physischen Welt statt (Embodied AI). Der Erfolg in den USA wird davon abhängen, ob das Stuttgarter Daten-Flywheel auch gegen die gigantischen Budgets der US-Konkurrenz bestehen kann. Sereact hat den Grundstein gelegt, um das „Gehirn“ der globalen Automatisierung zu werden.

Omegga sichert 10 Mio. EUR gegen das Kükentöten

Das 2020 gegründete Münchner Start-up Omegga sichert sich Seed-Kapital für seine optische KI-Spektroskopie. Unsere Marktanalyse.

Omegga wurde 2020 von Katharina Hesseler, Till Nöllgen und Paul Günther gegründet. Zum erweiterten Gründer:innenkreis gehören zudem Moritz Eder, Kyle Hiroyasu und Clara Kaufhold. Das Team bündelt Expertise in den Bereichen KI, Optik und industrielle Systeme. In den vergangenen Jahren entwickelte das Team seine Technologie kontinuierlich vom Prototypen zum Industriestandard weiter und konnte sich bereits 2023 eine Pre-Seed-Finanzierung sowie 2024 Fördermittel des European Innovation Council (EIC) sichern.

CEO und Mitgründerin Katharina Hesseler sieht in dem Einstieg der neuen Partner, die „tiefes technologisches Verständnis mitbringen“, ein „starkes Signal für das enorme Potenzial unseres Ansatzes, einen neuen Standard in der Industrie zu setzen“. Das frische Kapital soll in den gezielten Ausbau des Teams und die kommerzielle Skalierung der Technologie fließen.

Das Problem und die technologische Lösung

Der erste und bereits kommerziell verfügbare Use Case von Omegga widmet sich einem der massivsten ethischen Probleme der modernen Landwirtschaft. Jährlich werden weltweit Milliarden männlicher Küken direkt nach dem Schlüpfen getötet, da sie weder Eier legen noch für die Masthaltung wirtschaftlich nutzbar sind.

Mit der sogenannten spektralen Intelligenz – der Kombination aus KI und Spektroskopie – will Omegga das Unsichtbare sichtbar machen. Im Gegensatz zu vielen Marktbegleitern wählt Omegga einen rein optischen, nicht-invasiven Weg. Durch spezielle Kameras und Lichtfrequenzen werden die Eier im Brutkasten gescannt. Laut eigenen Angaben bietet das Start-up damit die früheste am Markt kommerziell verfügbare Technologie, um das Geschlecht noch vor dem Schlüpfen zu bestimmen. Das System ist bereits bei Kund*innen im laufenden industriellen Produktionsbetrieb im Einsatz.

Markt, Wettbewerb & regulatorischer Druck

Der Markt für das „In-Ovo-Sexing“ wächst rasant, primär getrieben durch den Gesetzgeber. In Deutschland ist das Kükentöten seit 2022 gesetzlich verboten, Frankreich zog nach, und ein EU-weites Verbot wird debattiert. Der Zwang zur Adaption in den Brütereien ist entsprechend hoch.

Omegga tritt in ein Feld ein, das bereits von finanzstarken Konkurrenten besetzt ist:

SELEGGT: Gilt als früher Pionier auf dem Markt. Das Unternehmen nutzt hormonelle Tests am 9. Bruttag, wofür das Ei mittels eines Lasers winzig klein geöffnet werden muss (minimal-invasiv).

In Ovo: Das niederländische Unternehmen setzt auf Flüssigkeitsanalysen mittels Massenspektrometrie am 9. Bruttag und sicherte sich erst kürzlich ein 42-Millionen-Euro-Darlehen der Europäischen Investitionsbank (EIB).

Agri Advanced Technologies (AAT): Die Tochter der EW Group dominiert weite Teile des Marktes mit hyperspektraler Bildgebung, die primär für braune Eier zwischen dem 11. und 13. Tag genutzt wird.

Der entscheidende Vorteil von Omegga: Die Methode kommt völlig ohne Verbrauchsmaterialien wie Chemikalien oder feine Nadeln aus. Da die Eier bei der rein optischen Methode unversehrt bleiben, entfällt das systembedingte Kontaminationsrisiko, das bei invasiven Verfahren entstehen kann.

Unsere Einordnung

Trotz der vielversprechenden Technologie steht Omegga vor Herausforderungen:

Hardware-Skalierung in rauen Umgebungen: Die Systeme müssen in den feuchten, warmen und staubigen Inkubatoren industrieller Brütereien über Jahre hinweg wartungsarm laufen. Hier muss das Start-up beweisen, dass sich die Technologie reibungslos in den globalen Massenbetrieb integrieren lässt.

Der regulatorische „Faktor Zeit“: Rein optische Modelle benötigen oft bis zum 12. Tag für eine verlässliche Auswertung. Sollte die Politik die „Tag 6“-Frist künftig strikt durchsetzen, müssen die KI-Modelle von Omegga beweisen, dass sie derart früh hochpräzise Ergebnisse liefern.

Die Plattform-Vision – Fluch oder Segen?

Omegga positioniert seine Lösung ausdrücklich als Plattformtechnologie für die Landwirtschaft, Lebensmittelproduktion und industrielle Qualitätskontrolle. Wie stark dieses Narrativ bei den Geldgebern verfängt, zeigen die Statements zur aktuellen Runde: Laut Christian Knott (Capnamic) entsteht hier eine Technologie „mit dem Potenzial, gleich mehrere Industrien grundlegend zu verändern“. Auch Mason Sinclair (IQ Capital) lobt die Schaffung einer „Plattform für die nicht-invasive und branchenübergreifende Materialanalyse“.

Dass solche Visionen bei Investor*innen beliebt sind, da sie den adressierbaren Markt massiv vergrößern, ist nachvollziehbar. Für ein 17-köpfiges Start-up birgt die gleichzeitige Erschließung neuer Industriezweige jedoch die Gefahr einer operativen Verzettelung. Der Fokus muss zunächst darauf liegen, den Geflügelmarkt zu durchdringen.

Fazit

Gelingt es Omegga, die rein optische Methode in der Breite zu skalieren und die Genauigkeit auf die allerersten Bruttage zu trainieren, hat das Münchner Start-up einen signifikanten Hebel gegen invasiv arbeitende Wettbewerber. Die 10-Millionen-Euro-Runde ist ein klarer Vertrauensbeweis der Investor*innen in einem schwierigen Funding-Umfeld.

Spritgeld für den Start-up-Motor: PR-Stunt oder genialer Dealflow-Generator? Der neue „GründerTank“ von Christopher Obereder im Check

Reisekosten, Tankrechnungen und Bahntickets sind für junge Bootstrapping-Start-ups oft schmerzhafte Posten. Der Münchner Investor und Ex-Silicon-Valley-Macher Christopher Obereder will mit einer neuen privaten Initiative für Start-ups in Deutschland genau hier ansetzen. Ein Gesamtbudget von bis zu 100.000 Euro steht für betriebliche Mobilitätskosten bereit. Doch hinter der pragmatischen Fördermittel-Story verbirgt sich ein überaus cleveres Geschäftsmodell zur Startup-Akquise. Eine Einordnung.

Wer den GründerTank verstehen will, muss zunächst auf seinen Initiator blicken. Christopher Obereder, in der Szene oft schlicht Startup-Chris genannt, ist kein Unbekannter. Bereits 2017 landete er als 26-Jähriger auf der renommierten „Forbes 30 Under 30“-Liste. Im Silicon Valley erarbeitete er sich einen Ruf als Experte für virales Marketing. Mit Exits und Engagements bei Hit-Apps wie Tellonym baute er sich finanzielles Gewicht auf. Durch medienwirksame Formate, wie die von ihm initiierte Bayern 3 Startup Challenge, brachte er das Thema Start-up-Finanzierung einem breiten Publikum nahe. Heute leitet er von Taufkirchen aus die Start-up-Chris Ventures GmbH und investiert gezielt in junge Tech-Unternehmen.

Spritgeld statt Folien-Bingo

Mit dem GründerTank, der von Unicorn AI unterstützt wird, ruft Obereder nun eine konkrete Mobilitätsförderung ins Leben. Der Fokus liegt dabei nicht auf schönen Präsentationen, sondern auf der harten operativen Realität. Unterstützt werden können je nach Einzelfall unter anderem Kraftstoffkosten für geschäftliche Fahrten, ÖPNV-Tickets, Carsharing oder Reisen zu Messen und Investoren.

Obereders Argumentation ist bestechend pragmatisch: „Wir tanken nicht nur Autos. Wir helfen Gründerinnen und Gründern, in Bewegung zu bleiben“, erklärt der Investor. „Viele Programme sprechen über Innovation. Mich interessiert, ob Gründer wirklich unterwegs sind, Kunden treffen, Feedback einsammeln und Momentum aufbauen. [...] Wenn Bewegung im Alltag ein echter Hebel ist, soll sie nicht an ein paar Rechnungen scheitern.“

Erstes gefördertes Start-up dieser Initiative ist Kluuu, eine innovative Lernplattform, die es Studierenden ermöglicht, ihren Lernstoff in interaktive Quizze umzuwandeln. Deren Vertreter Leon Sean Brown bestätigt den Schmerzpunkt vieler Start-ups: „Die Tankpreise sind hoch, operative Wege kosten Zeit und Geld, und genau dort entsteht oft der nächste Wachstumsschritt.“ Gerade in der frühen Phase zähle jeder Euro.

Der wahre Motor: Dealflow zum Discount-Tarif

Liest man die Ankündigung, wirkt das Projekt sehr wohlwollend. Doch bei genauerer Betrachtung erweist sich der GründerTank als strategisches Meisterstück der Dealflow-Generierung für Obereders Investmentvehikel.

- Geringer Kapitaleinsatz, maximaler Einblick: Die ausgelobten 100.000 Euro sind ein Gesamtbudget. Im Gegenzug für die Chance auf die Übernahme von Zugtickets oder Tankrechnungen reichen unzählige Start-ups ihre Unterlagen und Traktionsdaten ein. Für einen professionellen Investor ist dies ein unschlagbar kostengünstiger Weg, um an hochqualitative, topaktuelle Unternehmensdaten der umtriebigsten Frühphasen-Gründer*innen des Landes zu gelangen. Reguläre Venture-Capital-Fonds geben für das Scouting ein Vielfaches dieses Budgets aus.

- Skalierung durch künstliche Intelligenz: Die Flut an Bewerbungen wird nicht mühsam per Hand sortiert. Die eingereichten Unterlagen werden zunächst KI-gestützt vorbewertet. Die KI dient ausschließlich der Vorbewertung und Priorisierung, bevor am Ende Menschen die finale Auswahl treffen.

- Exzellentes PR-Narrativ: Die Story positioniert Obereder als echten „Hands-on“-Macher und adressiert ein spürbares Problem. Ein Rechtsanspruch auf Teilnahme oder Förderung besteht dabei ausdrücklich nicht, weshalb das finanzielle Risiko für den Initiator absolut gedeckelt ist.

Fazit: Mitfahren, aber smart

Sollten junge Unternehmerinnen und Unternehmer beim GründerTank mitmachen? Die Antwort lautet: Ja, aber mit strategischem Bewusstsein. Für Bootstrapping-Teams bietet das Programm eine unkomplizierte Hilfe. Wer den Zuschlag erhält, gewinnt nicht nur finanzielle Beinfreiheit, sondern landet unweigerlich auf dem Radar eines bestens vernetzten Investors.

Gründer*innen müssen sich jedoch des Tauschgeschäfts bewusst sein: Sie gewähren tiefe Einblicke in ihr Geschäftsmodell, um im Gegenzug potenziell Mobilitätskosten erstattet zu bekommen. Man sollte das Programm daher weniger als reine Spendenaktion betrachten, sondern vielmehr als das, was es im Kern ist: Einer der innovativsten und kosteneffizientesten Start-up-Scouting-Funnel der aktuellen Szene.

Nox Mobility: 2 Mio. EUR für den "Flugzeug-Killer" auf Schienen

Das Berliner Start-up Nox Mobility will mit privaten Zimmern im Nachtzug europäische Kurzstreckenflüge ersetzen. Eine 2-Millionen-Euro-Pre-Seed-Runde gibt erste Starthilfe. Doch der europäische Bahnmarkt ist ein hartes Pflaster für Gründende – erst 2024 scheiterte ein französischer Konkurrent mit exakt demselben Konzept. Eine Einordnung.

Es ist ein mutiges Versprechen in einem der am stärksten regulierten Märkte Europas: Das 2025 gegründete Mobilitäts-Start-up Nox Mobility will das europäische Nachtzug-Erlebnis revolutionieren. Dafür hat das Unternehmen nun eine Pre-Seed-Finanzierungsrunde in Höhe von 2 Millionen Euro abgeschlossen. Angeführt wird die Runde vom Frühphasen-Investor IBB Ventures. Mit an Bord sind zudem der italienische Investor Tommaso Lucca sowie Branchenköpfe wie HomeToGo-Mitgründer und CEO Dr. Patrick Andrae. Das frische Kapital soll primär in den Teamaufbau, die Vorbereitung der ersten Strecken für das Jahr 2027 sowie den Bau eines originalgetreuen Mockups der Zugkabinen fließen.

Rollendes Boutique-Hotel statt Abteilromantik

Während Nachtzüge aktuell zwar einen massiven Nachfrageboom erleben, ist der eigentliche Markt laut Nox Mobility zwischen 2001 und 2019 drastisch geschrumpft – von rund 1.200 wöchentlichen Verbindungen in Europa auf nur noch etwa 450. Nox will diese Lücke nun schließen und positioniert sich explizit nicht als klassisches Bahnunternehmen, sondern als direkte Alternative zum Kurzstreckenflug.

Der Clou: Das traditionelle Teilen von Schlafabteilen mit Fremden entfällt; stattdessen bekommt bei Nox Mobility jede(r) Reisende sein eigenes privates Zimmer mit Schlafplatz. Die Reise verbinde laut Nox die Zuverlässigkeit des Fliegens operativ mit dem Gefühl eines Boutique-Hotels. Abfahrten sollen abends an zentralen Bahnhöfen stattfinden, die Ankunft morgens direkt im Stadtzentrum – Flughafentransfers und Sicherheitskontrollen entfallen. Zielgruppe sind neben Freizeitreisenden vor allem Geschäftsreisende, für die eine Zugfahrt den frühen Abflug und eine zusätzliche Hotelübernachtung ersetzen soll. Preislich will Nox auf dem Niveau vergleichbarer Flugreisen agieren.

Das Gründerteam: Reichweite trifft auf operative Härte

Hinter dem Projekt steht ein Trio, das Branchenerfahrung, Skalierungswissen und bereits jetzt eine enorme Zielgruppe vereint:

Artur Hasselbach bringt als Mitgründer des Payment-Fintechs orderbird – das für über 140 Millionen Euro von Nexi übernommen wurde – ausgewiesene VC- und Tech-Erfahrung mit.

Janek Smalla kennt das harte operative Mobilitätsgeschäft aus seinen vorherigen Stationen bei FlixTrain und dem Mobilitätsanbieter Bolt.

Thibault Constant ist in der Nische ein Star: Mit "Simply Railway" hat er eine der größten Eisenbahn-Communities Europas mit über 600.000 Abonnenten aufgebaut. Er kennt die Probleme der Fahrgäste aus unzähligen Gesprächen und Zugfahrten aus erster Hand.

Die Gründer geben sich selbstbewusst und verkünden, das Rollmaterial für die Züge bereits gesichert zu haben.

Unsere Markteinordnung

Für uns stellt sich jedoch eine zentrale Frage: Kann man mit 2 Millionen Euro Pre-Seed-Kapital tatsächlich einen hochkomplexen Bahn-Infrastrukturbetrieb aufbauen? Die Antwort lautet: Nein, es ist lediglich das Ticket, um überhaupt an den Start zu gehen. Der Bau eines Mockups in Originalgröße ist das eine – die Finanzierung und Zulassung echter Züge für den Betrieb ab 2027 kostet schnell dreistellige Millionenbeträge.

Besonders kritisch wird das Vorhaben mit Blick auf die Konkurrenz und die jüngere europäische Start-up-Historie. Die Idee eines rollenden Hotels mit ausschließlich privaten Abteilen ist nicht neu. Das französische Start-up Midnight Trains startete 2020 mit extrem viel PR und fast exakt demselben Geschäftsmodell. Im Juni 2024 musste das Projekt jedoch Insolvenz anmelden. Die Gründer scheiterten daran, dass europäische VCs und Banken das massive finanzielle Risiko nicht tragen wollten und die europäische Schieneninfrastruktur historisch stark auf staatliche Monopolisten zugeschnitten ist, was neue Player systematisch benachteiligt.

Gleichzeitig schläft der etablierte Markt nicht: Die Österreichischen Bundesbahnen (ÖBB) dominieren mit ihrem Nightjet das Geschäft und haben mit ihren neuen „Mini Cabins“ (Schlafkapseln für Einzelpersonen) bereits auf den Wunsch nach mehr Privatsphäre reagiert.

Eine hochriskante Kapitalwette

Nox Mobility löst zweifellos ein echtes Problem und trifft den Nerv der Zeit in Sachen nachhaltiger Mobilität. Das Team aus Hasselbach, Smalla und Constant ist hervorragend aufgestellt und die Tatsache, dass sie nach eigenen Angaben bereits Züge gesichert haben, könnte der entscheidende Wettbewerbsvorteil gegenüber gescheiterten Projekten wie Midnight Trains sein.

Dennoch bleibt Nox Mobility eine hochriskante Kapitalwette. Die spannende Bewährungsprobe für das Berliner Start-up beginnt nicht erst 2027 auf den Schienen, sondern bereits in der nächsten Finanzierungsrunde: Dann wird sich zeigen, ob das Team Investor*innen davon überzeugen kann, die enormen Summen für den realen Bahnbetrieb aufzubringen – oder ob der Traum vom Start-up-Nachtzug im Trassendschungel Europas stecken bleibt.

UniteLabs: Der Münchner DeepTech-Herausforderer auf dem Weg zum globalen Labor-Standard?

Das 2024 von Robert Zechlin, Lukas Bromig und Julian Willand gegründete UniteLabs will die Laborautomatisierung von proprietären Hürden befreien. Nach einer Millionenfinanzierung folgte Anfang 2026 der offizielle US-Launch. Wir wollten wissen: Wie realistisch ist die Vision eines herstellerunabhängigen Standards in einem von Hardware-Silos dominierten Markt? Eine Analyse.

Wer heute ein hochmodernes BioTech-Labor betritt, erwartet nahtlos vernetzte HighTech-Forschung. Die Realität sieht oft anders aus: Rund 90 Prozent der Laborgeräte stammen von unterschiedlichen Hersteller*innen und sprechen schlichtweg nicht dieselbe technische Sprache. Um künstliche Intelligenz in der Forschung nutzbar zu machen, müssen hochqualifizierte Wissenschaftler*innen oft als Software-Ingenieur*innen einspringen und mühsam Schnittstellen programmieren. Genau diesen Flaschenhals will das Münchner DeepTech-Start-up UniteLabs beseitigen.

Die Gründer und der Sprung aus München

Hinter UniteLabs stehen Robert Zechlin, Lukas Bromig und Julian Willand. Nach Vorarbeiten ab 2022 wurde das Unternehmen 2024 offiziell gegründet. Das Team vereint interdisziplinäre Expertise aus Chemieingenieurwesen, Wirtschaftsinformatik und Unternehmensstrategie – eine essenzielle Mischung für ein Produkt, das tiefes Prozessverständnis mit modernster Softwarearchitektur verbinden muss.

Dass die Idee einen massiven Schmerzpunkt der Industrie trifft, zeigt die rasante Entwicklung der letzten Monate. Nach einer Pre-Seed-Finanzierungsrunde in Höhe von 2,77 Millionen Euro unter der Führung von NAP (ehemals Cavalry Ventures) im Januar 2025 und der Auszeichnung als „Bestes Münchner Start-up“ beim Munich Startup Award 2025 ist das Unternehmen sichtlich gewachsen. Im ersten Quartal 2026 zählt das Team im Münchner Inkubator Werk1 bereits rund 28 Köpfe.

Doch wie verhindert ein derart rasant wachsendes Team, bei der ständigen Anbindung neuer, exotischer Hardware nicht zu einer hochbezahlten IT-Manufaktur zu verkommen? Schließlich erfordert jedes neue Laborgerät auf dem Markt zunächst einmal Entwicklungsaufwand für den passenden Konnektor.

„Unser Ziel ist nicht, jedes exotische Gerät einzeln ‚irgendwie‘ anzubinden“, stellt Mitgründer Robert Zechlin klar. Vielmehr soll die Integration zu einer wiederholbaren Produktfähigkeit reifen. Statt sich im Klein-Klein der Modellnummern zu verlieren, baue UniteLabs seine Konnektoren entlang grundsätzlicher Geräte-Fähigkeiten. Die puren Herstellerspezifika landen dabei in einer dünnen Adapter-Schicht, während Workflows und Datensemantik konsistent bleiben.

Um die berüchtigte Skalierungsfalle zu umgehen, setzt das Start-up zudem verstärkt auf „Reusable Automation Assets“. „Wir investieren in validierte Workflow-Bausteine, Device-Profile und Test-Suites, mit denen die zweite und dritte Integration deutlich schneller wird als die erste“, betont Zechlin und skizziert damit den Weg zum echten SaaS-Unternehmen. Der Gründer gibt die Richtung selbstbewusst vor: „Die Grenzkosten für das nächste Gerät und den nächsten Standort müssen über Zeit sinken. Unser Endzustand ist ein Ökosystem, in dem Integrationen gemeinsame Infrastruktur sind, nicht Projektgeschäft.“

Vom Prototyp zur Architektur der offenen Labore

Im Februar 2026 hat UniteLabs auf der renommierten Branchenmesse SLAS in Boston den offiziellen US-Launch seines „AI-Ready Lab Automation Systems“ vollzogen. Statt nur isolierte Schnittstellen zu flicken, positioniert sich das Start-up nun mit einer klaren, dreiteiligen Architektur.

Den Kern bildet die Cloud-native „UniteLabs Platform“, die Hardware vernetzt und die Integration von Machine-Learning-Modellen in Echtzeit erlaubt. Ergänzt wird dies durch die lokale Anwendung „GroundControl“ für den Plug-and-Play-Anschluss von Geräten sowie das „UniteLabs SDK“. Letzteres ist ein Python-Werkzeug für Wissenschaftler*innen, um Labor-Workflows komplett als Code zu steuern. Dass diese Theorie praxistauglich ist, beweist das aufstrebende KI-BioTech-Unternehmen Cradle, das die Lücke zwischen Maschinen und digitalen Daten-Lakes intern bereits mit dem Münchner System schließt. Laut UniteLabs soll sich der Labor-Durchsatz für solche KI-getriebenen Forschungsteams durch die Plattform um bis zu das Vierfache steigern lassen.

Ein „Lab-as-Code“-Ansatz via Python mag für entwickleraffine Data Scientists verlockend sein – doch schließt er nicht paradoxerweise die klassischen Biolog*innen aus, für die Code-Workflows oft eine zu steile Lernkurve bedeuten?

„Code ist nicht das Produkt“, kontert Zechlin. Er sei vielmehr eine Schnittstelle, die sowohl Power-User als auch den Laboralltag bedienen müsse. Das SDK richte sich an Teams, die volle Kontrolle über Versionierung und automatisierte Tests verlangen – was im KI-BioTech-Umfeld zunehmend Standard sei. Zechlin räumt jedoch ein, dass das Programmieren nicht jedem liege: „Die meisten wollen zuverlässige Ausführung und klare Transparenz.“

Die Lösung der Münchner: Über die Orchestrierungsschicht und „GroundControl“ werden Workflows paketiert und mit Leitplanken versehen, sodass sie auch für Nicht-Entwickler sicher ausführbar sind. Code bleibt strategisch zwar die „universelle Abstraktion“ über Geräte hinweg, doch das Interface der Zukunft sieht anders aus. Zechlin blickt voraus: „Das User Interface für Wissenschaftler wird zunehmend KI-gesteuert und natürliche Sprache zum primären Interface. UniteLabs dient diesen KI-Applikationen als robuste Surface Area und Source of Truth.“ Die Leitplanke für das Wachstum fasst er in einem Satz zusammen: „Unsere Vision ist: flexibel, wo es Sinn macht, und kompromisslos robust, wo es zählen muss.“

Die Bewährungsprobe auf dem US-Markt

Nach dem Bostoner Launch steht das Start-up nun vor der monumentalen Aufgabe, sich im hochkompetitiven US-Markt zu behaupten. Hier entscheidet sich, ob UniteLabs vom europäischen Hoffnungsträger zum globalen Player reift. Umgeben von gigantischen Investitionen in die KI-Wirkstoffentwicklung reicht es nicht, nur ein weiteres Automatisierungstool zu sein – UniteLabs muss sich als essenzieller „Schaufelhersteller“ für den aktuellen Boom etablieren.

Dabei trifft man auf amerikanische Wettbewerber*innen, die teils mit hunderten Millionen Dollar Venture Capital ausgestattet sind. Wie überlebt ein Münchner Start-up mit einer Pre-Seed-Runde von knapp drei Millionen Euro diese Materialschlacht? Zechlin gibt sich pragmatisch und weicht dem direkten Finanz-Vergleich aus: „Klar: In Infrastrukturmärkten hilft Kapital, aber es ist nicht der entscheidende Hebel.“ Anstatt die Konkurrenz im reinen „Spend“ schlagen zu wollen, baue man auf messbaren Nutzen im Laborbetrieb.

Der Plan scheint aufzugehen: Ein Großteil von Umsatz und Pipeline stammt heute bereits aus den USA, wo UniteLabs Kund*innen an beiden Küsten bedient und mit großen Hardware-Hersteller*innenn kooperiert. „Wir planen für dieses Jahr unseren ersten Big Pharma Roll-out, der sowohl in Europa als auch an Standorten in den USA erfolgen soll“, verrät der Gründer. Um diese Dynamik zu finanzieren, hebe man aktuell eine 9-Millionen-Euro-Seed-Runde für die US-Expansion. Den strukturellen Wettbewerbsvorteil sieht Zechlin in der herstelleragnostischen Verbindung bestehender Geräte: „Statt Rip-and-Replace zu verlangen, werden Workflows schneller produktiv, Daten werden sauber mit Kontext versehen, und Teams können ‚Lab-as-Code‘ wirklich ausrollen.“

Ein strategischer Hebel ist dabei die Zielgruppenansprache. Statt in endlosen Vertriebszyklen mit dem C-Level großer Pharma-Konzerne zu ringen, treibt UniteLabs ein nutzer*innengetriebenes Wachstum voran. Labor-Ingenieur*innen, die durch das Python-SDK wochenlange Schnittstellenprogrammierung einsparen, tragen das System organisch in ihre Unternehmen. Dabei profitiert das Start-up enorm davon, selbst keine Pipettierroboter oder Analysegeräte herzustellen. Als „neutrale Schweiz“ der Labor-Hardware buhlt UniteLabs nicht um lukrative Geräteverkäufe – ein extrem starkes Argument gegen den gefürchteten Vendor-Lock-in amerikanischer Hardware-Giganten.

Stresstest für das Geschäftsmodell und Regularien

Doch die ambitionierte Plattform-Strategie wird kritisch geprüft werden. Das Geschäftsmodell birgt ein ständiges API-Katz-und-Maus-Spiel, da Schnittstellen zu teils stark abgeschirmten Systemen gebaut werden müssen. Wenn etablierte Hersteller*innen ihre Firmware ändern oder Drittanbieter-Zugriffe blockieren, explodieren schnell die Wartungskosten für die Konnektoren.

Bleibt die Frage an den Gründer: Was ist also der Plan B, wenn die Marktführer ihre Schnittstellen per Update plötzlich aktiv verschlüsseln? Reicht der Verweis auf offene Standards wie das SiLA2-Protokoll in der harten Praxis aus?

„Wir gehen davon aus, dass Hersteller ihre Ökosysteme schützen werden. Unsere Strategie darf deshalb nicht auf ‚Goodwill‘ bauen“, gibt sich Zechlin keinen Illusionen hin. Standards wie SiLA2 seien zwar hilfreich gegen Fragmentierung, aber „kein Schutzschild“. Der Ansatz der Münchner ist stattdessen pragmatisch und mehrstufig: Standards nutzen, wo verfügbar, und eigene robuste Adapter bauen, wo nötig. Zudem betreibe man ein Programm mit automatisierten Regressionstests am realen Geräteverhalten, um Fehler durch Updates früh zu erkennen.

Der zweite Baustein der Verteidigung ist kommerzieller Druck. Da Labore zunehmend „Best-of-Breed“-Lösungen kombinieren wollen, würden Hersteller, die Interoperabilität blockieren, zunehmend Deals riskieren. Im Hintergrund investiere man deshalb viel Arbeit in aktiv gepflegte Partnerschaften mit den Produzent*innen. Zechlins Plan B lautet letztlich Resilienz: „Mehrere Integrationspfade, starke Tests, und ein System, das stabil bleibt, auch wenn sich die Oberfläche verändert.“ Er ist sich sicher: „Langfristig wirkt die Ökonomie in Richtung Offenheit.“

Neben blockierender Hardware bleibt die US-Zulassungsbehörde FDA die vielleicht höchste Hürde auf dem Weg in den Enterprise-Markt. Deren strenge Vorgaben zu elektronischen Aufzeichnungen sind der größte Vorbehalt von Pharmaunternehmen gegenüber Cloud-basierten Systemen. Gelingt es UniteLabs, Offenheit mit lückenlosen Audit-Trails zu verknüpfen, könnten sie die berüchtigten Sales-Zyklen drastisch verkürzen.

Doch wie passt maximale Entwickler*innen-Freiheit durch Python-Skripte mit rigider FDA- und GxP-Compliance zusammen? Für Zechlin existiert dieser Widerspruch im Labor-Alltag schlichtweg nicht: „Compliance widerspricht Flexibilität nicht. Was widerspricht, ist unkontrollierte Veränderung.“

Um Big Pharma gerecht zu werden, behandle man hochflexible Workflows wie reguläre Software-Produkte: versioniert, testbar und auditierbar. „Ein Script ist in einem GxP-Kontext kein ‚jeder macht, was er will‘, sondern ein kontrolliertes Artefakt mit definierten Inputs, erwarteten Outputs und einem Validierungsnachweis“, unterstreicht der Mitgründer. Die Plattform trenne Sandbox-Entwicklungen von einer strikt kontrollierten Produktionsebene mit signierten Releases, Environment-Pinning und klarer Datenlineage. Zechlin formuliert einen selbstbewussten Anspruch an die Branche: „Das Labor holt Software-Best-Practices nach. Unser Anspruch ist, ‚compliant by design‘ zur Default-Einstellung für AI-ready Lab Ops zu machen.“

Fazit

UniteLabs hat exzellentes Timing bewiesen. Die BioTech-Branche lechzt nach KI, scheitert aber noch massenhaft an isolierten Daten. Durch das Bereitstellen essenzieller Daten-Infrastruktur haben sich die Münchner in eine starke Ausgangsposition manövriert. Der US-Launch und anstehende Messepräsentationen zeugen vom Anspruch der Gründer. Der ultimative Lackmustest ab 2026 wird jedoch sein, ob die Hardware-Hersteller*innen diesen Wandel dulden – oder den Kampf um ihre lukrativen Software-Margen eröffnen.

Bleibt die Frage nach dem viel zitierten „Endgame“: Baut das Start-up wirklich das globale Betriebssystem für Biotech-Labore, oder macht man sich letztlich nur als hochattraktives Übernahmeziel für Hardware-Giganten hübsch?

Auf diese Entweder-Oder-Frage antwortet Zechlin diplomatisch, aber ambitioniert: „Unsere Vision ist, die neutrale Betriebsschicht für moderne Labore zu werden, weil die Branche einen herstellerunabhängigen Standard braucht, nicht noch ein weiteres Einzellösungstool.“ Gleichzeitig sei man Realist: Infrastruktur zähle nur, wenn sie im Alltag zuverlässig genutzt werde und verlässliche, strukturierte Daten für KI liefere.

Sollte das gelingen, hält sich UniteLabs alle Optionen offen – von der unabhängigen Kategorie-Definition über strategische Partnerschaften bis hin zum Exit. Doch auf einen schnellen Verkauf schiele man nicht, verspricht Zechlin: „Wir bauen nicht für eine Übernahme. Wir bauen so, dass der Markt die Plattform ernst nehmen muss.“ Und am Ende solle ohnehin der/die Kund*in profitieren: „Weniger Silos, schnellere Science, und ein Ökosystem, in dem Innovation nicht an proprietären Schnittstellen hängen bleibt.“

Gründer*in der Woche: Pax Lupus – Mit KI und Drohnen gegen den Wolf

Wolfsbiss in Hamburg: Die Debatte brennt. Das Start-up Pax Lupus von Anna-Karina Katt und Karsten Schmiegel will Herden nun autonom mit KI und Drohnen schützen.

Die Rückkehr des Wolfes nach Deutschland erreicht eine neue Eskalationsstufe: Am 30. März 2026 kam es in einem Einkaufszentrum in Hamburg-Altona zur Bissverletzung einer Frau durch einen Wolf. Es ist der erste Vorfall dieser Art seit der Wiederansiedlung der Tiere vor fast 30 Jahren. Obwohl die betroffene Frau das Universitätsklinikum nach ambulanter Behandlung inzwischen verlassen konnte, ist die Debatte um den Umgang mit dem Raubtier voll entbrannt.

Alexander Bonde, Generalsekretär der Deutschen Bundesstiftung Umwelt (DBU), stellt in diesem Kontext klar: Aus Artenschutzperspektive sei die Rückkehr des Wolfs positiv, doch Wölfe gehören in die Natur und nicht in Städte. Für die freie Natur komme es laut Bonde nun auf wirtschaftliche und praktische Schutzmechanismen an, die ein Nebeneinander von Wild- und Nutztieren ermöglichen. Genau hier setzt das von der DBU mit der „Green Startup“-Förderung unterstützte Unternehmen Pax Lupus an.

Gründer*innen & Vision

Hinter Pax Lupus steht das Gründungsduo Anna-Karina Katt und Karsten Schmiegel. Die beiden haben sich dem Thema Herdenschutz verschrieben und entwickeln ein autonomes System zur nicht-tödlichen Abwehr von Wolfsrudeln. Ihre Motivation speist sich auch aus der Kritik an gängigen Praktiken: Laut Anna-Karina Katt seien etablierte Maßnahmen wie Zäune, Netze und Herdenschutzhunde nicht nur arbeitsintensiv, sondern teils auch umweltschädigend. Besonders die engmaschigen Kunststoffnetze seien kurzlebig und produzierten große Mengen an nicht-recyclebarem Müll. Ein weiteres Problem laut Katt: Andere Wildtiere wie Rehe oder Feldhasen verfangen sich in diesen Netzen, was nicht selten zu schweren Verletzungen oder gar zum Verenden führe.

Das Produkt: Autonome Luftabwehr statt Plastiknetz

Das von Katt und Schmiegel entwickelte Herdenschutzsystem soll völlig netzunabhängig und nach einem mehrstufigen Prinzip auf Basis künstlicher Intelligenz (KI) arbeiten. Für die Überwachung und Sensorik wird in der Mitte der Weide ein Mast aufgestellt, der mit Kameras und Sensoren ausgestattet ist und über Solarmodule mit Strom versorgt wird. Diese Sensoren überwachen Tag und Nacht einen Radius von bis zu 200 Metern und sollen erkennen, wenn sich ein Wolf nähert. Die entwickelte Technik soll dabei zuverlässig Menschen oder andere Tiere von Wölfen unterscheiden, sodass bei harmlosen Weidebesuchern kein Alarm ausgelöst wird.

Wird tatsächlich ein Wolf registriert, eskalieren die Abwehrmaßnahmen schrittweise zur Vergrämung. Aus der Basisstation steigt eine kleine Drohne auf, fliegt das Tier gezielt an und soll es durch entsprechende Manöver vertreiben. Um auch eine Echtzeit-Intervention zu ermöglichen, werden die Schäferinnen und Schäfer bei bestehender Netzabdeckung zeitgleich über den Vorfall alarmiert. Sie können die Lage dann über Kameras zusätzlich einschätzen und die Drohnen-Abwehr bei Bedarf manuell abbrechen. Laut Anna-Karina Katt vertreibt das System Wölfe nicht nur situativ: Durch wiederholte Vergrämung sollen Wölfe lernen, die Weidetiere auch langfristig zu meiden. Dies ermögliche es den Schäfer*innen, lediglich einen einfachen Grundschutz wie Weidezäune aufzustellen.

Geschäftsmodell & Marktanalyse

Pax Lupus bewegt sich in der wachsenden Nische des Agri-Tech und liefert einen innovativen Ansatz für ein hoch emotionales und drängendes Problem in der Landwirtschaft. Beim Vertrieb setzt das Start-up auf den Verkauf sowie das Leasing des Systems und bietet zudem die Übernahme der Wartung an. Die darüber hinaus geplanten „Notfall-Mieten“ bei akuten Wolfsrissen sind strategisch klug positioniert. Damit senkt Pax Lupus die Einstiegshürde für betroffene Schäfer*innen enorm und platziert das Produkt direkt dort, wo der akute Bedarf entsteht.

Der rein deutsche Markt für Wolfsschutz ist trotz stetig wachsender Population zunächst auf klassische Weidebetriebe limitiert. Um als Start-up skalieren zu können, ist die von Pax Lupus geplante Ausweitung auf andere Nutztiere wie Kühe, Pferde oder Hühner entscheidend. Das angedachte KI-Training zur Abwehr von weiteren Raubtieren wie Füchsen oder Kojoten öffnet zudem potenziell die Tür zu internationalen Märkten.

Die stärksten Wettbewerber*innen bleiben vorerst etablierte Zäune und Herdenschutzhunde. Pax Lupus muss beweisen, dass die Gesamtkosten ihres Hightech-Systems für oft margenschwache Weidebetriebe attraktiv sind. Zudem stehen Hardware-Startups immer vor physischen Hürden: Die Solartechnik und Drohnenmechanik müssen auch bei widrigem Wetter fehlerfrei funktionieren.

Fazit

Pax Lupus kombiniert auf clevere Weise Tierschutz mit moderner KI und entlastet Weidetierhalter. Gelingt es dem Startup, die Hardwarekosten wettbewerbsfähig zu halten und die Software zügig auf weitere Raubtierarten auszuweiten, könnte dieses System den Herdenschutz nachhaltig verändern. Letztlich schützt Technologie hier nicht nur das Schaf, sondern hilft laut Anna-Karina Katt auch, artenreiche Offenlandschaften wie Bergweiden, Heide und Deiche als wichtigen Bestandteil Mitteleuropas zu erhalten.

Peak Quantum sichert sich 2,2 Mio. Euro für fehlerresistente Qubits

Peak Quantum holt 2,2 Mio. Euro für fehlerresistente Qubits. Wie das Münchner Spin-off mit EU-Förderung gegen die hochgerüstete Konkurrenz antritt.

München wächst weiter als Europas Quanten-Hauptstadt. Das Start-up Peak Quantum schließt seine Pre-Seed-Runde mit 2,2 Millionen Euro ab und positioniert sich im hart umkämpften Deep-Tech-Markt. Der Pitch der Gründer: Fehlerkorrektur direkt in der Hardware. Doch in einem extrem kapitalintensiven Umfeld reicht Geld allein nicht. Wie das Spin-off mit einem cleveren Infrastruktur-Schachzug gegen die hochgerüstete europäische Konkurrenz bestehen will.

Aus der Forschung in die Praxis

Im Jahr 2024 entstand Peak Quantum als Spin-off aus der Forschungsgruppe von Prof. Stefan Filipp am Walther-Meißner-Institut (WMI), das zur Bayerischen Akademie der Wissenschaften gehört. Das Gründungsteam deckt interdisziplinär die gesamte Wertschöpfungskette vom Chipdesign bis zur Systemintegration ab. Zu den Köpfen hinter der Unternehmung gehören Leon Koch (CEO), Alexander Schult (CFO), Dr. Thomas Luschmann (COO), Dr. Max Werninghaus (CSO), Ivan Tsitsilin (Head of Design), Kedar Honasoge (Head of Production) und Daniil Bazulin (Quantum Engineer). Unterstützt wird das junge Unternehmen durch wichtige Säulen des lokalen Ökosystems wie dem Munich Quantum Valley und der UnternehmerTUM.

„Hardware-First“ statt Software-Pflaster

Das aktuell größte Hindernis im Quantencomputing ist das sogenannte Rauschen – die enorme Fehleranfälligkeit der Recheneinheiten (Qubits). Während die Industrie bisher stark darauf setzte, schlicht die Anzahl physikalischer Qubits hochzuskalieren und Fehler nachträglich per Software zu korrigieren, wählt Peak Quantum einen grundlegend anderen Weg. Das Start-up entwickelt supraleitende Prozessoren, deren physikalische Architektur Fehler bereits auf der reinen Hardware-Ebene unterdrückt. Dieser integrierte Fehlerschutz soll die Komplexität des Gesamtsystems drastisch senken und die Entwicklung kommerziell nutzbarer Rechner massiv beschleunigen.

Das Geschäftsmodell & der EU-Infrastruktur-Hebel

Quanten-Hardware ist ein unfassbar teures Pflaster. Mit dem frischen Kapital von Investor*innen wie dem britischen Lead-Investor Cloudberry Ventures, United Founders oder QAI Ventures steigt die Gesamtfinanzierung von Peak Quantum auf gut fünf Millionen Euro. Für den Aufbau eigener Reinräume (CapEx) reicht das kaum. Der strategische Clou des Geschäftsmodells liegt daher in der europäischen Vernetzung: Peak Quantum bezieht öffentliche Fördermittel aus dem EU Chips Act und wurde ausgewählt, die im April 2026 startende Quantenchip-Pilotlinie SUPREME zu betreiben.

Ziel ist es, in Europa eine skalierbare Produktionsumgebung zu etablieren, die langfristig auch für externe Partner geöffnet werden soll. Ein Modell, das es Peak Quantum erlaubt, trotz einer frühen Finanzierungsphase hocheffizient an industrietauglichen Chips zu feilen.

Der Markt & die Konkurrenz

Doch der Markt verzeiht keine Verzögerungen, und München ist längst ein Haifischbecken der Quantentechnologie. Direkt vor der Haustür sitzen Schwergewichte:

- IQM Quantum Computers: Der europäische Platzhirsch für supraleitende Quantencomputer (mit Hauptsitz in Finnland, aber großem Zentrum in München), der kürzlich eine SPAC-Fusion für einen geplanten Milliarden-Börsengang ankündigte.

- planqc: Ein weiteres Münchner Spin-off, das auf neutrale Atome setzt und bereits 2024 eine Series A in Höhe von satten 50 Millionen Euro abschloss.

- Alice & Bob: Auf internationaler Ebene steht besonders das französische Start-up Alice & Bob in direkter technischer Konkurrenz. Die Pariser entwickeln sogenannte Cat Qubits, die ebenfalls hardwareseitig fehlerresistent sind, und kooperieren dabei bereits eng mit Microsofts Quanten-Sparte.

Fazit: Risiko und enorme Chance

Das Board rund um einen ehemaligen Alphabet-X-Advisor sieht in Peak Quantum ein elementares Puzzleteil für ein eigenständiges europäisches Quanten-Ökosystem. Die Investition ist ein klassisches „Deep-Tech-Infrastruktur-Play“.

Dennoch ist eine Pre-Seed-Runde von 2,2 Millionen Euro im Jahr 2026 angesichts der Kapitalausstattung der Konkurrenz eine riskante Wette. Peak Quantum muss durch den Zugang zur SUPREME-Pilotlinie extrem schnell beweisen, dass die fehlerresistente Architektur industriell skaliert und nicht nur im Labor des WMI funktioniert.

Bringt das Team um Leon Koch erste greifbare Pilotprojekte mit Forschungs- und Industriepartnern in den Bereichen Materialforschung, Logistik oder industrieller Optimierung zum Laufen, könnte Peak Quantum zu einem technologischen Flaschenhals werden, an dem in Europa niemand mehr vorbeikommt. Es ist das Paradebeispiel dafür, wie smarte Gründer*innen nicht nur Code oder Hardware schreiben, sondern das System aus Fördergeldern, Pilotlinien und lokaler Forschungsexzellenz maximal zu ihrem Vorteil hebeln.

Steckrübe statt Schwein: Verrano sichert sich hohe sechsstellige Finanzierung für die „Clean Label“-Revolution

Das 2023 gegründete Frankfurter Start-up Verrano hat ein neuartiges Verfahren entwickelt, das regionales Wurzelgemüse durch Reifung und Räucherung in eine pflanzliche Alternative zu Wurstersatzprodukten verwandelt.

Hinter Verrano, das Anfang 2023 in Frankurt/Main gegründet wurde, steht ein branchenerfahrenes, dreiköpfiges Gründerteam rund um Geschäftsführer Manuel Siskowski. Die Idee reifte jedoch schon lange vor der formellen Gründung. Getreu dem internen Motto „natürlich köstlich“ experimentierten die Gründer – zu denen auch Maximilian Bubenheim mit seiner Erfahrung aus der Sternegastronomie sowie Felix Linnenschmidt gehören – mehrere Jahre mit Wurzelgemüse.

Dabei wendeten sie ein Verfahren an, das in ähnlicher Form beim Reifen von klassischem Schinken zum Einsatz kommt. Nach ersten erfolgreichen Testläufen im regionalen Bio-Handel konnten bald die ersten Kund*innen mit Mengen aus der in Biebertal bei Gießen installierten Pilotanlage beliefert werden.

Handwerkstradition trifft Gemüse

Anstatt klassische Fleischersatzprodukte nachzuahmen, setzt Verrano auf die handwerkliche Veredelung. Regionale Rohstoffe wie Steckrübe, Sellerie und Rote Beete werden einem speziellen Fermentations- und Räucherverfahren unterzogen. Das Endprodukt zeichnet sich durch einen enormen Gemüseanteil von rund 95 Prozent aus und kommt mit nur wenigen Zutaten aus, ohne künstliche Zusatzstoffe zu verwenden. Das Ergebnis soll laut Unternehmensangaben in seiner Textur und dem Geschmack an hochwertige Fleischprodukte wie Schinken erinnern. Die kulinarischen Kreationen werden bereits als dünner Aufschnitt, im Würfelmix oder am Stück in den Markt eingeführt und eignen sich flexibel als Brotbelag, zum Kochen oder für Snackplatten. Die Innovationskraft dieses Ansatzes wurde kürzlich von PETA mit dem „VEGAN AWARD 2026“ in der Kategorie „beste vegane Innovation“ ausgezeichnet.

Eine neue Kategorie jenseits der Imitation

Der Markt für pflanzliche Alternativen konsolidiert sich aktuell, während die Lebensmittelbranche verstärkt nach innovativen pflanzlichen Produkten sucht, die neue Geschmackserlebnisse erzeugen. Hier positioniert sich Verrano in der stark wachsenden Nische der „Clean Label“-Produkte. Direkte Wettbewerber*innen mit einem identischen Ansatz sind rar, da die meisten großen Player*innen weiterhin auf Extrusionsverfahren von Proteinisolaten setzen. Verrano erschafft vielmehr eine neue Kategorie: Eine pflanzliche Feinkost, die das Naturprodukt Gemüse transformiert. Dass diese Nische massentauglich ist, bewies das Start-up jüngst im Veganuary durch aufmerksamkeitsstarke Listungen deutschlandweit in den Bordbistros der Deutschen Bahn.

Die Herausforderungen am Markt

Trotz der vielversprechenden Traction und der Skalierbarkeit, die bereits mit der Pilotanlage bewiesen wurde, steht das Start-up vor großen operativen Herausforderungen, um den Start im breiten Handel zu ermöglichen. Ein Reifeprozess, der Wochen in Anspruch nimmt, bindet extrem viel Working Capital, da enorme Mengen vorproduziert und gelagert werden müssen. Zudem verhält sich Gemüse im Reifeprozess mikrobiologisch grundlegend anders als Fleisch. Die Qualitätssicherung erfordert hochpräzise Produktionsumgebungen, um die Haltbarkeit bei größeren Mengen zu garantieren. Letztlich bedarf es auch starker Aufklärungsarbeit und forcierter Vertriebsaktivitäten am Konsument*innen, um Wurzelgemüse dauerhaft als Premium-Feinkostprodukt zu etablieren.

Reale Skalierung statt VC-Hype

Genau bei diesen Herausforderungen zeigt sich die strategische Passung der aktuellen Finanzierungsrunde. Dass Verrano die bestehenden Produktionskapazitäten massiv ausweiten muss, um die ansteigende Nachfrage zu bedienen, ist der klassische Flaschenhals von Food-Start-ups. Der überwiegende Teil der eingeworbenen Mittel fließt in genau diesen Zweck. Dass die Finanzierungsrunde dabei, wie StartingUp aus Branchenkreisen erfuhr, im hohen sechsstelligen Bereich liegt, beweist die Kapitaleffizienz des Unternehmens. Anstatt reines Risikokapital in teure Eigenentwicklungen zu pumpen, setzt Verrano auf „Smart Money“.

Mit dem Maschinenbauer Weber Food Technology und der Wurst- und Schinkenmanufaktur Bedford holen sie sich zwei strategische Industrie-Schwergewichte an Bord. Verrano profitiert hier direkt von jahrzehntelanger Expertise in der mikrobiologischen Reifung sowie im industriellen High-Tech-Slicing. Zusammen mit der BMH, die als VC-Tochter der Helaba aktuell Fonds mit einem Volumen von 450 Millionen Euro verwaltet, hat das Start-up starke Partner für die anstehende Geschäftsentwicklung gewonnen. Dieses Konsortium bietet das Rüstzeug, um die Nische der veganen Boutiquen zu verlassen und den Lebensmitteleinzelhandel zu adressieren.

Gründer*in der Woche: SpeakerMatching.com – Disruption auf der Bühne

Die Eventbranche wächst, doch die Suche nach den passenden Köpfen für die Bühne gleicht oft noch einem analogen Kraftakt. Mit der Plattform SpeakerMatching.com will eine erfahrene Seriengründerin den Spieß nun umdrehen. Es ist ein klassisches Plattform-Play ohne die üblichen Vermittlungsprovisionen – doch kann sich das Modell gegen etablierte Branchengrößen durchsetzen? Wir haben die Gründerin Henriette Hochstein-Frädrich befragt.

Hinter SpeakerMatching.com, im November 2025 als B2B-Marktplatz gelauncht, steht Henriette Hochstein-Frädrich. Sie kennt den Schmerz der Branche nicht nur vom Hörensagen. „Ich kenne den Markt nicht nur als Plattformunternehmerin, sondern auch aus zwei weiteren sehr praktischen Perspektiven: Seit vielen Jahren stehe ich selbst als Speakerin und Moderatorin auf Bühnen, und zugleich habe ich eigene Eventformate und Veranstaltungsreihen im Bereich modernes Female Empowerment konzipiert und umgesetzt“, erinnert sich die Gründerin.

„Gerade als Veranstalterin wurde mir immer wieder bewusst, wie zeitaufwendig, intransparent und teilweise zufallsgetrieben die Suche nach passenden Rednerinnen sein kann“, bringt sie das Kernproblem auf den Punkt. Gleichzeitig habe sie beobachtet, wie sich der Markt zunehmend professionalisiere: „Es gibt mehr Expertinnen, mehr Themen, mehr Formate, aber bislang keine wirklich zeitgemäße digitale Infrastruktur, die Angebot und Nachfrage effizient zusammenführt.“

Dass sie diese Infrastruktur bauen kann, hat sie in der Vergangenheit bewiesen: 2009 gründete sie Pharmatching.com, baute es zur Branchengröße auf und verkaufte es 2017. „Aus meinen früheren Plattformgründungen habe ich vor allem drei zentrale Lektionen mitgenommen: Erfolgreiche Marktplätze lösen ein echtes, konkretes Problem. Vertrauen und Qualität sind im B2B-Umfeld entscheidend. Und nicht zuletzt spielt Timing eine größere Rolle, als viele denken“, betont Hochstein-Frädrich.

Rollentausch statt Kaltakquise

Das Timing sei deshalb ideal, weil Veranstaltende heute Plattformlogiken und Self-Service-Modelle erwarten, wie sie sie aus anderen B2B-Märkten längst kennen. Der Kern von SpeakerMatching.com liegt in der Umkehrung des klassischen Buchungsprozesses. Veranstaltende formulieren ihr Gesuch kostenfrei auf der Plattform, woraufhin sich Speaker*innen direkt bewerben können. Das Start-up finanziert sich stattdessen über Abonnements für die Rednerinnen.

„Uns war von Anfang an wichtig, ein sehr niedrigschwelliges und zugleich faires Preismodell für Speaker*innen zu schaffen“, rechnet die Geschäftsführerin vor. Die monatlichen Mitgliedschaften liegen zwischen rund 59 und 89 Euro. „Wenn über die Plattform ein einzelner Auftrag im mittleren vierstelligen Bereich zustande kommt, hat sich die Investition für viele Redner*innen bereits mehrfach amortisiert.“ Sie stellt aber auch klar: „SpeakerMatching.com ist ein Marktplatz, kein Management- oder Vermittlungsvertrag.“

Doch wie verhindert man eine Flut an unpassenden Bewerbungen? „Die Sorge vor einer unüberschaubaren Bewerbungsflut ist absolut nachvollziehbar, gerade bei offenen Plattformmodellen“, räumt die Gründerin ein. Da Veranstaltende jedoch Parameter wie Budget, Zielgruppe oder Sprache sehr konkret vorgeben, entstehe eine starke Vorfilterung. „Unsere bisherigen Erfahrungen aus den ersten Monaten zeigen sehr deutlich: Unpassende ‚Blindbewerbungen‘ sind die absolute Ausnahme“, versichert Hochstein-Frädrich. Zwar sollen perspektivisch KI-basierte Funktionen eine stärkere Rolle spielen, doch die Vision bleibt menschlich: „Unser Ziel ist daher kein vollständig automatisiertes ‚Black-Box-Matching‘, sondern eine intelligente Plattform, die Entscheidungsprozesse vereinfacht und die Qualität der Interaktionen erhöht.“

Um das Problem des Bypassings – also den Abschluss an der Plattform vorbei – zu umgehen, werden Event-Gesuche zunächst anonymisiert veröffentlicht. „Erst wenn sie passende Bewerbungen erhalten und aktiv in den Austausch gehen möchten, geben sie ihre Identität preis“, erklärt die Gründerin den Prozess. „Wenn Speaker*innen über SpeakerMatching.com kontinuierlich relevante Anfragen erhalten und Veranstaltende effizient passende Expertinnen finden, entsteht eine stabile Win-Win-Dynamik. Genau darauf ist das Modell ausgelegt.“

Markt, Wettbewerb und organisches Wachstum

Der Markt wächst kontinuierlich, wird aber von großen Redneragenturen wie Speakers Excellence oder Premium Speakers dominiert. Diese arbeiten stark kuratiert und rufen oft hohe Vermittlungsprovisionen auf. Um in diesem zweiseitigen Markt das klassische Henne-Ei-Problem zu überwinden, verzichtet die Plattform auf der Veranstaltendenseite auf Gebühren.

Finanziert ist das Vorhaben bisher weitgehend aus eigener Kraft. „Aus meinen früheren Gründungen weiß ich, wie wichtig es gerade in der frühen Phase eines zweiseitigen Marktplatzes ist, Produkt, Zielgruppe und Marktmechanik zunächst sehr präzise zu verstehen und organisch zu entwickeln“, lautet ihr Credo. „Plattformmodelle brauchen Zeit, Vertrauen und kritische Masse, das lässt sich nicht ausschließlich mit Kapital ‚beschleunigen‘, sondern vor allem durch konsequenten Nutzen für beide Marktseiten“.

Dabei grenzt sie sich bewusst von stark kuratierten Agenturen ab. Der Mix aus etablierten Persönlichkeiten und neuen Stimmen sei genau das, was der Markt heute suche. Viele Unternehmen wünschen sich heute bewusst mehr Vielfalt auf ihren Bühnen. „Dabei verstehen wir Diversität nicht nur im klassischen demografischen Sinn, sondern auch als Vielfalt an Perspektiven, Erfahrungen und Denkweisen“, so Hochstein-Frädrich.

Den Vorstoß in Richtung Full-Service-Agenturen samt Ausfallversicherungen bremst sie indes ab. „Im Moment konzentrieren wir uns bewusst darauf, das Matching selbst so gut wie möglich zu machen. Alles Weitere kann – zumindest vorerst – auch von anderen Playern im Ökosystem übernommen werden.“

Fazit

Das Speaker-Business ist traditionell ein echtes People Business. Bei Keynotes für teils fünfstellige Honorare verlassen sich viele Großkund*innen gern auf die persönliche Beratung einer Agentur, die im Krankheitsfall sofort für Ersatz sorgt. Diesen Full-Service kann ein Self-Service-Marktplatz aktuell nur schwer vollumfänglich abbilden.

Dennoch ist SpeakerMatching.com ein mutiger und zeitgemäßer Angriff auf die verkrusteten und provisionsgetriebenen Strukturen der Eventbranche. Gelingt es, rasch eine kritische Masse an hochwertigen Event-Gesuchen zu generieren, hat die Plattform das Potenzial, Angebot und Nachfrage künftig deutlich schneller zusammenzubringen.

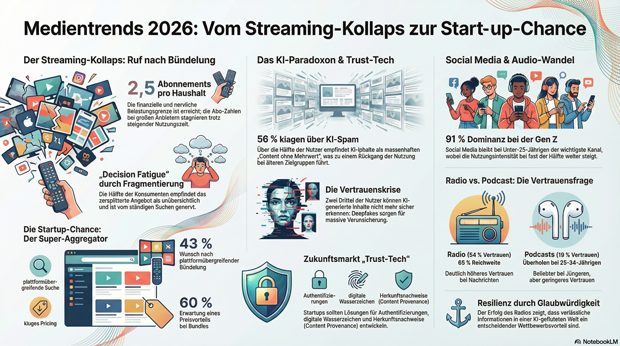

Mediennutzung 2026: Zwischen KI-Frust, Abo-Müdigkeit und neuen Chancen für Start-ups

Die Deutschen experimentieren so intensiv wie nie mit künstlicher Intelligenz (KI), sind aber zunehmend genervt von Deepfakes und „Content ohne Mehrwert“. Gleichzeitig sehnt sich der überhitzte Streaming-Markt nach einer drastischen Konsolidierung. Die aktuelle Deloitte-Studie „Media Consumer Trends 2026“ liefert nicht nur Bestandsaufnahmen, sondern zeigt deutlich, wo für Gründer*innen und Tech-Unternehmen jetzt die wahren Opportunitäten liegen.

Social Media bleibt der unangefochtene Platzhirsch der Medienlandschaft: 78 Prozent der Konsument*innen in Deutschland sind auf den Plattformen aktiv, bei der Gen Z (unter 25 Jahre) sind es sogar satte 91 Prozent. Fast die Hälfte dieser jungen Zielgruppe nutzt Instagram, TikTok und Co. heute intensiver als noch im Vorjahr. Doch ein Blick unter die Oberfläche offenbart Risse im digitalen Fundament – und die haben maßgeblich mit dem rasanten Einzug generativer künstlicher Intelligenz (KI) zu tun.

Das KI-Paradoxon: Große Kreationslust, massives Vertrauensproblem

Auf der Creator-Seite ist KI bereits Alltag. 22 Prozent der Befragten haben laut Deloitte schon Bilder per KI erstellt, jeder Zehnte generiert Videos oder Musik. Auch die Zahlungsbereitschaft ist überraschend hoch: Jeder Fünfte wäre bereit, monatlich über 10 Euro für entsprechende Tools auszugeben.

Auf der Konsument*innenseite jedoch kippt die Stimmung bedenklich. Zwei Drittel der Nutzer*innen geben an, dass sie KI-generierte Inhalte im Netz nicht mehr zuverlässig erkennen können. Schlimmer noch: 56 Prozent klagen über eine wachsende Flut an KI-generierten Postings „ohne Mehrwert“ – schlichtweg digitaler Spam. Die Konsequenz dieser Verunsicherung zeigt sich bereits in den Nutzungsdaten: Erste Altersgruppen, insbesondere Nutzer*innen ab Mitte 50, beginnen, ihren Social-Media-Konsum aktiv zurückzufahren.

Die Start-up-Perspektive: Die Zeiten des blinden KI-Hypes sind vorbei. Wer als Gründer*in heute rein quantitativ auf automatisierte Content-Erstellung setzt, riskiert Reichweite und Glaubwürdigkeit. Wie Deloitte-Expertin Sophie Pastowski anmerkt, braucht es dringend „transparente Kennzeichnung, um Vertrauen im digitalen Raum zu stärken.“ Genau hier entsteht ein massiver Zukunftsmarkt für „Trust-Tech“-Start-ups: Werkzeuge, die Authentizität verifizieren, Deepfakes zuverlässig herausfiltern, digitale Wasserzeichen etablieren oder Content-Provenance (Herkunftsnachweise) sichern, werden zu kritischen Erfolgsfaktoren für Plattformen und Verlage.

Streaming-Kollaps: Die Sehnsucht nach dem Super-Aggregator

Auch im Video-Streaming-Markt (SVoD) stehen die Zeichen auf Wandel. Der Markt ist in einer Reifephase angekommen: Zwar verbringen die Deutschen immer mehr Zeit mit Streaming, doch die Abo-Zahlen stagnieren. Mit durchschnittlich 2,5 Abos bei 64 Prozent der Haushalte ist die finanzielle und nervliche Schmerzgrenze offenbar erreicht.

Die Fragmentierung des Marktes wird zum Bumerang. Die Hälfte der Konsument*innen findet das zersplitterte Angebot unübersichtlich; das ständige Suchen nach Inhalten über verschiedene Apps hinweg („Decision Fatigue“) nervt. Das Resultat ist ein lauter Ruf nach Bündelung: 43 Prozent der Nutzer*innen wünschen sich eine plattformübergreifende Aggregation ihrer Dienste. Der Haken für Anbietende: 60 Prozent erwarten im Gegenzug für ein solches Bundle einen spürbaren Preisvorteil.

Die Start-up-Perspektive: Der Markt schreit nach einer funktionierenden Meta-Ebene. Wer es schafft, die zersplitterte Content-Landschaft in einer nutzer*innenfreundlichen Oberfläche (Super-App) mit intelligenter, plattformübergreifender Suchfunktion und klugem Pricing zu bündeln, trifft den absoluten Nerv der Zeit. Das reine Hinzufügen eines weiteren Nischen-Streamingdienstes dürfte es hingegen 2026 schwerer denn je haben.

Audio: Der harte Kampf um das knappe Gut „Glaubwürdigkeit“

Im Audio-Segment setzt sich der Strukturwandel fort. Podcasts boomen weiter und haben bei den 25- bis 34-Jährigen das klassische Radio bereits als wichtigstes Medium überholt. Doch das Radio verzeichnet mit 65 Prozent wöchentlicher Reichweite weiterhin eine enorme Resilienz. Der Grund ist ein entscheidender USP, von dem digitale Kanäle lernen können: Vertrauen. Wenn es um harte Informationen und die Nachrichtenlage geht, stufen 54 Prozent der Hörer das Radio als informativer und verlässlicher ein – Podcasts kommen hier nur auf 19 Prozent.

Fazit

Die Mediennutzung 2026 ist stark paradox geprägt: Technologie durchdringt die Erstellung von Inhalten immer tiefer, doch die Sehnsucht der Nutzer*innen nach Authentizität, Übersichtlichkeit und verlässlichen Quellen wächst proportional dazu. Für Start-ups bedeutet dies einen strategischen Paradigmenwechsel. Nicht das nächste Tool zur Erstellung von noch mehr billigem KI-Content ist der heilige Gral, sondern Lösungen, die in der Informationsflut Orientierung schaffen, Fragmentierung auflösen und echtes Vertrauen im digitalen Raum aufbauen. Wer diese Schmerzpunkte adressiert, hat im hart umkämpften Medienmarkt der kommenden Jahre exzellente Karten.

Vom Solinger Start-up zum globalen Einhorn: Wie Dash0 die Observability-Giganten dekonstruiert

Das 2023 gegründete KI-Start-up Dash0 hat im März 2026 mit einer 110-Millionen-Dollar-Runde die magische Milliardenbewertung geknackt. Die Vision: Die Systemüberwachung von Software durch offene Standards, radikal faire Preismodelle und pragmatische KI zu revolutionieren. Doch der Frontalangriff auf US-Goliaths wie Datadog birgt strategische Risiken.

In der modernen Softwareentwicklung ertrinken IT-Teams in einer Flut aus Warnmeldungen, Logs und Metriken. Klassische Überwachungs-Tools (Observability) sind oft teuer, komplex und sperren Kunden in geschlossene Daten-Ökosysteme ein. Genau dieses Problem adressiert Dash0 – und hat damit in Rekordzeit Investoren und namhafte Kunden überzeugt. „Systemüberwachung ist heute kaputt: Sie ist zu laut, zu teuer und zu komplex“, bringt es Dash0-CEO und Mitgründer Mirko Novakovic auf den Punkt.

Die Gründer und der rasante Aufstieg zum Einhorn

Hinter Dash0 steht ein Quintett erfahrener Tech-Veteranen. Besonders Mirko Novakovic ist in der B2B-Szene ein Schwergewicht: 2020 verkaufte er sein vorheriges Start-up Instana für rund 500 Millionen US-Dollar an IBM. Dieser „Repeat Founder“-Status erklärt das enorme Vertrauen der Geldgeber.

Die Historie von Dash0 liest sich wie ein Start-up-Märchen im Zeitraffer: Nach der Gründung 2023 im nordrhein-westfälischen Solingen folgte Ende 2024 eine 9,5-Millionen-Dollar-Seed-Runde parallel zum Produktlaunch. Ein Jahr später sammelte das Team 35 Millionen Dollar ein.