Aktuelle Events

Nachhaltigkeit in der Logistik

Auf den deutschen Autobahnen reihen sich kilometerweise LKW aneinander – und 20 Prozent von ihnen fahren leer. Das ist nicht nur ein Ärgernis für Autofahrer*innen und eine kostspielige Angelegenheit für Unternehmen, sondern bringt auch verheerende Folgen für die Umwelt mit sich. Wie die Digitalisierung der Logistik zu mehr Nachhaltigkeit und Effizienz verhelfen kann.

Es ist unumstritten, dass die fehlende Nachhaltigkeit eine der größten Kehrseiten der Logistik und insbesondere des Straßengüterverkehrs ist. Doch Leerfahrten und dadurch vermehrte CO2-Emissionen sind größtenteils auf die Organisation und den hohen Koordinationsaufwand von Aufträgen zurückzuführen. Die Auftragsvermittlung für eine einzige Fahrt birgt schier endlose Kommunikationsketten, manuellen Schriftverkehr und die Einbindung zahlreicher Interessengruppen.

Die fehlende Vernetzung der Logistik

Während sich die meisten Branchen in den vergangenen Jahrzehnten digitalisiert haben, und so mit digitalen Tools effizientere Lösungen mit höherem Nutzen für alle Beteiligte schaffen konnten, arbeitet die Logistik noch heute oftmals wie vor 20 Jahren. Aufträge von verladenden Unternehmen werden auf Seiten der Fuhrunternehmen manuell bearbeitet: per Telefon, E-Mail und Excel-Tabellen. Das bedeutet, dass Disponenten die hoch komplexe Aufgabe erfüllen müssen, per Excel-Tabellen eine Vielzahl an LKW auszulasten.

Eine weitere Eigenschaft der Logistik, die durch die mangelnde Vernetzung verschärft wird, ist die hohe Anzahl an Subunternehmen, die in der Branche tätig sind. Kann ein Unternehmen aufgrund von unvorhersehbaren Ereignissen wie Erkrankungen, Pannen oder Verspätungen von Fahrzeugen einen Auftrag nicht erfüllen, geben sie diesen an Subunternehmen weiter – und zwar oftmals per Telefon. Das führt häufig dazu, dass weder Auftraggeber noch Fuhrunternehmen wissen, wo sich die Lieferung befindet, wann sie zugestellt wird oder gar wer diese Fahrt überhaupt durchführt.

Eine zentrale Vernetzung aller Beteiligten der Lieferkette gibt es derzeit nicht. Darunter leiden Effizienz und Umwelt gleichermaßen und so legen noch zu oft leere statt voll beladene LKW hunderte von Kilometern zurück.

Mehr Effizienz und Nachhaltigkeit durch Digitalisierung

Eines ist sicher: Die Vernetzung aller Akteure auf einer Plattform würde der Logistik zu der dringend notwendigen Transparenz verhelfen. Transparenz darüber, wer wann und wie involviert ist, wo sich eine Lieferung befindet, wann sie ankommt und ob sich gegebenenfalls passende Ladungen in der Nähe eines Zustellortes befinden.

Ein Disponent kann so beispielsweise digital auf einer Plattform den entsprechenden Ort eintragen, an dem eine Ladung gebraucht wird. Ein Algorithmus matcht dann die passenden Treffer. Kommunikation zwischen Auftraggeber und Fuhrunternehmen findet direkt auf der Plattform statt. Durch GPS-Tracking der LKW kann genau eingesehen werden, wo sich eine Ladung befindet, wann sie geliefert wird, und ob eine Anschlussladung dazugebucht werden kann.

Die Digitalisierung der Prozesse führt demnach nicht nur zu hinreichend ausgelasteten LKW und Kosteneinsparungen bei Verladern und Fuhrunternehmen, sondern verhilft der ganzen Branche auch zu mehr Transparenz und einem verbesserten Nachhaltigkeitsbewusstsein. Statt tausender Kilometer an Leerfahrten, würden sich mittels der Plattform nahezu nur noch vollbeladene LKW in einem optimal durchdachten Streckennetz bewegen. Kurzum: Eine Win-Win-Situation für die gesamte Branche.

Der Autor Tom Krause ist CEO des Hamburger Logistik-Technologie-Start-ups Cargonexx. Das Unternehmen vernetzt Frachtführer mit verladenden Unternehmen aus der Logistikbranche und trägt damit zu mehr Effizienz und weniger Leerfahrten bei.

Diese Artikel könnten Sie auch interessieren:

Investforum Pitch-Day 2026 bringt Startups und Innovationen nach Dessau

Am 16. September 2026 findet im Technikmuseum Hugo Junkers in Dessau der nächste Investforum Pitch-Day statt. Das etablierte Startup- und Matching-Event zählt zu den wichtigsten Formaten für Frühphasen-, Gründungs- und Wachstumsfinanzierung in Sachsen-Anhalt und bringt seit mittlerweile 17 Jahren innovative Startups, Investoren, Unternehmen und Netzwerkpartner aus ganz Deutschland zusammen.

Gesucht werden branchenübergreifend Teams mit skalierbaren Geschäftsmodellen, innovativen Technologien und Wachstumspotenzial – unter anderem aus den Bereichen KI & Software, Bio & Life Science, Clean Tech, FinTech, Food, Consumer Products oder E-Commerce. Auch Forschungsprojekte mit verwertbaren Ergebnissen und konkretem Anwendungspotenzial können sich bewerben.

Im Mittelpunkt stehen kompakte Pitch-Sessions, kuratierte 1:1-Matchings mit Investoren und direkter Austausch mit Branchenakteuren. Zusätzlich profitieren die ausgewählten Teams von einer professionellen Vorbereitung durch Workshops, Pitchtrainings sowie Unterstützung bei Pitch- und Read Decks.

Darüber hinaus bietet der Investforum Pitch-Day Networking mit Business Angels, VCs und Unternehmen sowie Keynotes rund um Innovation und Wachstum. Ein weiterer Höhepunkt ist die Verleihung des Awards „Überzeugendstes Startup“ der Stadtwerke Halle GmbH, dotiert mit 2.500 Euro, sowie des „TK-Sonderpreis Gesundheit“ der Techniker Krankenkasse Sachsen-Anhalt, dotiert mit 1.000 Euro.

Mit der HANGAR Night erwartet die Teilnehmenden außerdem ein besonderes Abendformat mit Innovation Walks, Drinks, Live-Musik und Austausch in außergewöhnlicher Atmosphäre.

Die Bewerbungsphase läuft noch bis zum 14. Juni 2026. Weitere Informationen zu Teilnahmebedingungen, Förderung und Bewerbung gibt es unter: pitchday.investforum.de

Der Investforum Pitch-Day 2026 ist ein Angebot der IMPETUUM GmbH – Institut für Wissens- und Technologietransfer an der Martin-Luther-Universität Halle-Wittenberg – und wird durch das Ministerium für Wirtschaft, Tourismus, Landwirtschaft und Forsten mit Mitteln des Europäischen Sozialfonds Plus und des Landes Sachsen-Anhalt gefördert

1 Mio. Euro ARR ohne Investor*innen: Der kalkulierte Drahtseilakt von Inno KI

Eine Million Euro ARR in zwei Jahren – ganz ohne Investor*innen. Wie das Start-up Inno KI den VC-Hype ignoriert und sein B2B-Geschäft nutzt, um mutige B2C-Testballons zu finanzieren.

Das KI-Start-up Inno KI aus dem niedersächsischen Vechta vermeldet einen Meilenstein: Im Mai 2026 – rund zwei Jahre nach der Gründung – hat das Unternehmen die Marke von einer Million Euro Annual Recurring Revenue (ARR) erreicht. Das Besondere daran: Dieser Aufbau gelang vollständig aus eigenem Startkapital und ohne externes Wachstumskapital. In einem Markt, der primär von milliardenschweren Risikokapitalrunden Schlagzeilen macht, horcht die Szene auf. Ein genauerer Blick auf das Geschäftsmodell zeigt jedoch: Die Unabhängigkeit hat ihren Preis – und ermöglicht zugleich überraschende strategische Freiheiten.

Vom Agentur-Projekt zur DSGVO-Plattform

Die Historie von Inno KI zeigt einen klassischen pragmatischen Ansatz. Das Unternehmen entstand unter anderem aus der Marketing-Agentur moin media und der Magic Labs GmbH, die bereits ab 2022 intensiv mit KI-Anwendungen experimentierten. Aus der Kernfrage, wie Mitarbeiter rechtssicher und datenschutzkonform mit Künstlicher Intelligenz arbeiten können, wurde Ende 2024 schließlich die Plattform innoGPT gelauncht.

Hinter dem Projekt stehen die Gründer Mike Koene und Maurice Brumund, der als Geschäftsführer agiert. Das von ihnen entwickelte Produkt fungiert als Brücke zu den großen Sprach- und Bildgenerierungsmodellen der US-Konzerne und europäischer Entwickler*innen – darunter OpenAI, Anthropic, Google, Meta und Mistral sowie Black Forest Labs. Der entscheidende Hebel für den deutschen Mittelstand: Die Plattform ist komplett DSGVO-konform und wird auf Servern in Deutschland innerhalb der EU gehostet. Laut Unternehmensangaben nutzen bereits über 1.000 Unternehmen und mehr als 600 Professionals das System täglich, unterstützt von einem Netzwerk aus über 30 Vertriebspartnern. Zu den namhaften Kund*innen zählen Schwergewichte wie PwC, die GC Gruppe, Hansa-Flex und die Böckmann Fahrzeugwerke.

Die ARR-Metrik im Branchen-Check

Innerhalb der Start-up-Welt ist die Kennzahl ARR (Annual Recurring Revenue) ein hoch bewertetes Gut, da sie in der Regel für planbare und hochskalierbare Abo-Einnahmen steht. Inno KI erklärt in seiner Mitteilung, dass die Plattform derzeit mit rund 30 Prozent pro Monat wächst. Gleichzeitig fließen Einnahmen aus begleitendem KI-Consulting und intensiven Schulungen direkt in die Weiterentwicklung des Produkts.

Für Analyst*innen zeigt sich hier ein interessanter Hybrid: Während klassische SaaS-Investoren oft eine strikte Trennung von reinen Software-Lizenzen und schwer skalierbaren Dienstleistungen fordern, nutzt Inno KI eine starke Verknüpfung beider Welten. Consulting und das vom Unternehmen angebotene Change-Management sind zeit- und personalintensiv. Das aktuelle Wachstum wird somit maßgeblich durch ein Systemhaus-ähnliches Modell querfinanziert. Das senkt zwar das finanzielle Risiko enorm, wirft bei Tech-Puristen aber unweigerlich die Frage auf, wie schnell sich das Modell global ohne massiven Personaleinsatz skalieren lässt.

Technologische Tiefe vs. „Middleware“-Dilemma

Technologisch bewegt sich innoGPT im Bereich der Middleware. Das Start-up entwickelt keine eigenen Foundation-Modelle, sondern legt eine datenschutzkonforme Schnittstellen-Hülle über bestehende Drittanbieter-Technologien. In der Tech-Szene wird bei solchen Modellen oft die Tiefe des technologischen „Burggrabens“ hinterfragt.

Den oft geäußerten Vorwurf, ein reiner „API-Wrapper“ zu sein, kontert Inno KI jedoch mit einer eigenen technologischen Wertschöpfungsschicht: Wie StartingUp bereits in der Meldung zum B2C-Vorstoß von innoGPT berichtete, nutzt das System eine "Named Entity Recognition". Dabei werden sensible personenbezogene Daten in hochgeladenen Dokumenten automatisch durch Platzhalter ersetzt, bevor sie überhaupt an die Schnittstellen der US-Anbieter*innen gesendet werden.

Zusätzlich zu diesem technischen Datenschutz bleibt die Strategie stark auf die menschliche Komponente fokussiert: Da die Einführung von KI primär die Veränderung von Arbeitsweisen bedeutet, ist das operative Change-Management ein fester Bestandteil der Leistung geworden. Die Kund*innenbindung erfolgt also maßgeblich durch Beratungs- und Implementierungskompetenz vor Ort.

B2B als Cashcow für den B2C-Testballon

Geschäftsführer Maurice Brumund betont, dass man Angebote von Kapitalgeber*innen bewusst abgelehnt habe. Der Verzicht auf Venture Capital sichere dem Unternehmen die Unabhängigkeit von harten Quartalsvorgaben externer Investoren, die fast immer einen schnellen Exit anstreben. Für Kund*innen wolle man so ein stabilerer, langfristiger Partner sein.

Genau diese Unabhängigkeit erklärt auch die ungewöhnlichen strategischen Züge des Start-ups. Die Gewinne aus dem B2B-Kerngeschäft dienen als Motor für neuartige Experimente. Wie wir kürzlich berichteten, wagt sich Inno KI mit einem „Family Package“ (34,90 Euro/Monat) an den ungelösten datenschutzkonformen KI-Zugang für Familien und das Kinderzimmer heran. Ein derartiger B2C-Testballon für ein B2B-fokussiertes Unternehmen wäre unter dem strengen Fokus klassischer VC-Geber*innen, die meist eine eindimensionale Skalierung im Kerngeschäft fordern, kaum denkbar gewesen.

Fazit

Inno KI liefert ein starkes Beispiel für erfolgreiches Bootstrapping im deutschen Tech-Sektor. Dem Team ist es gelungen, die akute Compliance-Unsicherheit des Mittelstands schnell und profitabel zu monetarisieren. Der Fall zeigt Gründer*innen, dass ein tragfähiges Geschäftsmodell im KI-Bereich nicht zwingend auf Milliardeninvestitionen basieren muss, wenn die vertriebliche Nische und der Service stimmen. Ob sich das Hybrid-Modell langfristig gegen die fortschreitende Marktkonsolidierung der Tech-Riesen behauptet, wird sich zeigen – doch vorerst nutzt Inno KI seine finanzielle Freiheit konsequent für eigene Wege.

Mikroben statt Chemie: Wie BlueActivity den Milliardenmarkt der Kühlwasserbehandlung aufmischt

Das 2021 gegründete Heidelberger CleanTech-Start-up BlueActivity ersetzt klassische Biozide in industriellen Kühlanlagen durch natürliche Mikroorganismen. Mit einer frischen ISO-Zertifizierung und Millionenkapital im Rücken stehen die Zeichen auf Skalierung. Doch wie belastbar ist das biologische Geschäftsmodell im harten, sicherheitsfokussierten Industriealltag?

Gegründet wurde die BlueActivity GmbH im Jahr 2021 von Lars Havighorst und Michael Simon. Die Vision der Gründer: Die industrielle Wasserbehandlung für Verdunstungskühlanlagen grundlegend zu verändern und dabei Ökonomie und Ökologie in Einklang zu bringen. Anstatt potenziell umweltgefährdende Chemikalien – insbesondere toxische Biozide – in die Kühlkreisläufe der Industrie zu leiten, setzt das Startup auf funktionelle Mikroorganismen und Biopolymere.

Der innovative, patentierte Ansatz hat am Kapitalmarkt überzeugt: Bis heute konnte BlueActivity ein Gesamtinvestment von 8,5 Millionen Euro einsammeln. Zu den Geldgebern gehören neben Business Angels auch Branchen-Investoren wie Venture Stars, Wind VC und Angel Invest. Mit den Mitteln soll vor allem die Skalierung und Durchdringung europäischer Industriemärkte vorangetrieben werden.

Das Geschäftsmodell – Klares Wertversprechen mit technischer Hürde

BlueActivity verspricht seinen Industriekunden durch die patentierte Technologie signifikante Effizienzsteigerungen und Kosteneinsparungen. Die Leistungsdaten lauten gemessen an den herkömmlichen Verfahren wie folgt (Unternehmensangaben):

- Reduzierung des Wasserverbrauchs um bis zu 40 %.

- Senkung der direkten Betriebskosten (OPEX) um bis zu 32 %.

- Performance-Steigerung von Kühlanlagen um bis zu 29 %.

- Vollständiger Verzicht auf umweltgefährdende Biozide.

Kritisch hinterfragt

Das ökologische und ökonomische Wertversprechen ist hoch, doch das biologische Verfahren birgt verfahrenstechnische Herausforderungen. Biologische Prozesse reagieren naturgemäß sensibler auf äußere Einflüsse als etablierte chemische Verfahren. Während herkömmliche Biozide verlässlich und rigoros sämtliches mikrobielle Leben (darunter auch gefährliche Legionellen) im Kühlwasser abtöten, erfordert der probiotische Ansatz von BlueActivity eine kontinuierliche, präzise Überwachung. Das Überleben und die Wirksamkeit der eingesetzten Mikroorganismen müssen auch bei starken industriellen Temperaturschwankungen und variierenden Wasserqualitäten lückenlos garantiert werden. Die größte Hürde für das Start-up bleibt es daher, den Nachweis absoluter Prozessstabilität im Dauereinsatz bei Großkund*innen zu erbringen.

Der Markt und der Wettbewerb

Der Markt für industrielle Kühlwasserbehandlung ist ein globales Seriengeschäft, das traditionell von finanzstarken Großkonzernen wie Ecolab, Kurita oder Solenis dominiert wird. Diese etablierten Akteure verfügen über jahrzehntelange Kundenbeziehungen und setzen im Kern auf bewährte, biozidbasierte Behandlungsprogramme.

Für BlueActivity spielt jedoch das sich verschärfende regulatorische Umfeld eine entscheidende Rolle. Die gesetzlichen Vorgaben für Abwassereinleitungen und den Umgang mit Gefahrstoffen steigen europaweit kontinuierlich an. BlueActivity garantiert hier die Compliance mit den strengen Vorgaben der VDI 2047 sowie der 42. BImSchV (Bundes-Immissionsschutzverordnung). Zudem wächst durch ESG-Kriterien und die CSRD-Berichterstattung der Druck auf Industrieunternehmen, nachhaltige Lieferketten nachzuweisen. Dass dieser Ansatz an Relevanz gewinnt, zeigt auch die Anerkennung der Technologie durch den Verein Deutscher Ingenieure (VDI) als zukunftsweisende Technologie im Jahr 2026.

Der nächste Meilenstein: Zertifiziertes Vertrauen im B2B-Sektor

Um in der eher konservativen Industrie als junges Unternehmen Vertrauen aufzubauen, hat BlueActivity einen wichtigen formalen Schritt vollzogen: Im April 2026 erhielt das Unternehmen die Zertifizierung nach DIN EN ISO 9001:2015.

Die international anerkannte Norm bestätigt dem Startup die erfolgreiche Einführung eines strukturierten Qualitätsmanagementsystems, das vom Vertrieb über die Inbetriebnahme bis hin zum Service greift. CEO Lars Havighorst ordnet den Schritt ein: „Die ISO-Zertifizierung ist für uns ein wichtiger Meilenstein. Sie zeigt unseren Kunden und Partnern, dass wir nicht nur technologisch innovativ sind, sondern auch in unseren Prozessen höchste Standards einhalten.“ Für das CleanTech-Unternehmen, das nach eigenen Angaben bereits einen Jahresumsatz im siebenstelligen Bereich erwirtschaftet, bildet diese Professionalisierung das fundamentale Sprungbrett für das weitere nationale und internationale Wachstum.

Was Gründer*innen von BlueActivity lernen können

Für die Start-up-Szene liefert die Entwicklung von BlueActivity wichtige Learnings im B2B- und DeepTech-Segment:

- Regulatorik als Hebel nutzen: Wer strenge gesetzliche Vorgaben (wie die 42. BImSchV) antizipiert, kann aus regulatorischem Druck ein funktionierendes B2B-Geschäftsmodell formen.

- Prozesssicherheit schlägt reine Innovation: In traditionellen Industriezweigen reicht ein gutes Produkt allein nicht aus. Zertifikate wie die ISO 9001:2015 fungieren als geschäftskritische Türöffner, um das inhärente Risiko der Zusammenarbeit mit einem Start-up zu minimieren.

- Investor*innen-Fokus auf harten Impact: Das Gesamtinvestment von 8,5 Millionen Euro belegt, dass Venture-Capital-Gesellschaften bereitwillig in hardware- und prozessorientierte CleanTech-Lösungen investieren, sofern ein klar bezifferbarer wirtschaftlicher Nutzwert (OPEX- und Wasserreduktion) für den Endkund*innen nachweisbar ist.

Marlow: Kein Führerschein, aber das Auto neu gedacht

Die Gründer Florian Ritzel und Jannik Kirchhoff aus Hamburg wollen das Problem der versteckten Autokosten lösen. Ihre App Fahrfuchs* kletterte ohne Marketingbudget in die Top 100 der Finanz-Charts im App Store – eine klassische Bootstrapping-Erfolgsgeschichte. Doch wie tragfähig ist das Geschäftsmodell, wenn etablierte Konkurrenten den Markt beherrschen?

* Hinweis der Redaktion (29.05.26): Aufgrund eines Copyright-Streits mussten die Gründer ihre App umbenennen – diese heißt jetzt Marlow statt Fahrfuchs.

Während andere Abiturient*innen für Klausuren büffeln, programmierten Florian Ritzel und sein Mitgründer Jannik Kirchhoff (beide 18) ein Start-up. Die Initialzündung war laut den beiden Hamburger Gymnasiasten eine gesellschaftliche Beobachtung: Die Belastung durch Mobilitätskosten. „Die alleinerziehende Mutter sollte nicht an der Zapfsäule stehen müssen und entscheiden, ob sie ihr Kind in die Kita oder sich selbst zur Arbeit fährt“, beschreibt Ritzel die Motivation hinter dem Projekt. Die amüsante Ironie ihrer Gründung: Die Marlow-Gründer besitzen aktuell nicht einmal einen Führerschein.

Auf die naheliegende Skepsis bezüglich dieses fehlenden „Nutzer-Wissens“ reagiert Florian Ritzel offensiv: „Natürlich gibt es immer Leute, die unsere Idee kritisieren. Und fehlendes Nutzerwissen ist gerade am Anfang schwierig, vor allem, wenn man eine App bauen möchte, die möglichst vielen Menschen hilft.“ Doch aus der vermeintlichen Schwäche machten sie eine Stärke durch maximale Nutzerorientierung. „Wir haben bereits vorher im Umfeld rumgefragt, was die Leute eigentlich brauchen, und danach gezielt um Feedback gebeten“, erklärt der Gründer. Der Erfolg gibt ihnen recht: „Inzwischen erreichen uns täglich dutzende Mails mit Tipps – was die Nutzer*innen sich wünschen und wie wir die App verbessern können. Dadurch wird uns das Ganze nicht zum Verhängnis, sondern sogar zum Vorteil.“

Mit Marlow wollen sie den rund 48,5 Millionen Pkw-Halter*innen in Deutschland auf den Cent genau aufzeigen, wo das Auto wirklich Geld frisst. Denn der teure Kraftstoff ist nur ein Teil der Wahrheit. Falsche Versicherungstarife, unbemerkter Wertverlust, Wartung und vergessene Pendlerpauschalen reißen oft weitaus größere Löcher ins Budget. Die Resonanz ist für die frühe Phase beachtlich: Ganz ohne bezahltes Marketing sammelte die App schnell über 700 Downloads ein – eine für den Massenmarkt zwar noch bescheidene Zahl, die jedoch ausreichte, um mehrfach in die Top 100 der Finanz-Charts im App Store zu stürmen. Zudem generierte das Projekt rein organisch Presseberichte, unter anderem in der FAZ, der SWP und bei Antenne Bayern.

Holistischer Ansatz statt reiner Tank-App

Auf den ersten Blick wirkt Marlow wie ein weiterer Spritpreis-Radar. Die App zieht in Echtzeit Daten der Markttransparenzstelle für Kraftstoffe, listet Ladesäulen für E-Autos und alarmiert per Push-Nachricht bei günstigen Preisen. Der entscheidende Pivot ist jedoch das ganzheitliche Kostentracking: Die Gründer haben einen eigenen Versicherungsrechner sowie einen Steuer-Sparrechner integriert, bieten detaillierte Monatsreports an und binden die Nutzer*innen über einen Gamification-Ansatz („Sparfuchs-Score“). Ein zentrales Versprechen in Zeiten von Datenskandalen: Alle sensiblen Nutzer*innendaten werden lokal auf dem Endgerät gespeichert – es gibt keine zentrale Cloud.

Angesprochen auf die Skalierbarkeit dieses Modells bezieht Jannik Kirchhoff klar Stellung: „Die lokale Datenspeicherung ist gerade in Deutschland kein strategisches Eigentor. Ich halte nichts für wichtiger, als die privaten Daten unserer Nutzer*innen zu schützen“. Er warnt vor den Risiken zentraler Speicherlösungen: „Niemand muss wissen, wo ich wohne, wohin ich morgens fahre oder wo meine Kinder zur Kita gehen. Wir haben in der Vergangenheit immer wieder gesehen, dass jeder gehackt werden kann. Und gerade als junge Entwickler können und wollen wir diese Verantwortung nicht übernehmen“. Personalisierte Spar-Vorschläge ließen sich laut Kirchhoff auch direkt auf dem Smartphone „hervorragend realisieren“.

Ein echtes Haifischbecken

Die Vision ist ambitioniert, doch der Markt ist hart umkämpft. Die Konkurrenz reicht von Excel-Tabellen bis zu Platzhirschen wie Spritmonitor oder Giganten wie Clever Tanken. Warum also wechseln? Florian Ritzel gibt sich selbstbewusst: „Die Spritpreis-Übersicht ist bei uns nur eines von vielen Features – nicht der Hauptteil. Wer Spritmonitor so gut findet, darf dort gerne bleiben.“ Der Fokus liege woanders: „Wer aber wirklich tracken möchte, was sein Auto insgesamt kostet, der kann das eben nur bei uns. Diese Gesamtheit an Features gibt es bisher in keiner anderen App in dieser Form.“ Selbst das Argument der manuellen Excel-Tabelle lässt er nicht gelten: „Natürlich kann man sich das selbst in Excel bauen – aber darauf haben die meisten Leute schlicht keine Lust. Genau deswegen sind wir so gut.“

Kritisch hinterfragt

Trotz des Aufklärungscharakters ist Marlow kein reines Hobbyprojekt; In-App-Käufe für eine „Plus“-Version (0,99 €/Monat) sowie eine „Pro“-Version (2,99 €/Monat bzw. 19,99 €/Jahr) bilden das Monetarisierungsmodell. Ob die selbstgestrickte Mathematik hinter dem Versicherungsrechner, der auf hunderten per Hand durchgerechneten Profilen basiert, ohne echte API-Schnittstellen dauerhaft standhält, bleibt abzuwarten.

Wie viele Abonnent*innen braucht es, um nach dem Abitur davon zu leben? Jannik Kirchhoff rechnet vor: „Ehrlicherweise vermutlich mehr als 10.000 zahlende Abonnent*innen – aber das ist zunächst auch nicht unser Ziel.“ Aktuell stehe das Lernen im Vordergrund: „Wir wollen vor allem Erfahrungen sammeln durch das, was wir machen, und gleichzeitig die laufenden Kosten decken. Das sollte demnächst möglich sein.“

Für die Zeit nach dem Abschluss hält er sich alle Türen offen: „Risikokapital halte ich ab dem Moment für unumgänglich, an dem wir wirklich konkret expandieren wollen. Das wird vermutlich nach dem Abitur der Fall sein. Dann muss man schauen, ob es sich lohnt, Anteile abzugeben oder Kredite aufzunehmen.“ Sein Fazit: „Spannend wird es erst, wenn wir die Idee wirklich groß skalieren wollen.“

Ein exzellentes MVP mit Pivot-Potenzial

Marlow ist ein Lehrbuchbeispiel für ein hervorragendes Minimum Viable Product (MVP). Um jedoch hochprofitabel zu werden, könnte mittelfristig ein Wechsel hin zur Affiliate-Provision für Versicherungswechsel nötig sein. Doch hier bremst Florian Ritzel bewusst: „Versicherungspartner wollen wir zunächst bewusst nicht werden, denn einer der entscheidendsten Punkte unserer App ist, dass wir Versicherungsdaten unabhängig zur Verfügung stellen.“

Sein Ziel ist technologische Exzellenz: „Meilenstein eins ist, den Versicherungsrechner so akkurat zu machen, dass wir auf Check24-Niveau sind – ohne dafür Provisionen zu kassieren.“ Zudem plane man Kooperationen mit Fahrschulen und Werkstätten, um die Leute genau dort zu erreichen, „wo sie am meisten ans Auto denken“. Die größte Hürde bleibt derweil technischer Natur: „Meilenstein drei ist die Android-Version – das ist allerdings extrem schwer umzusetzen, gerade wenn man iOS-Coding gewohnt ist.“ Dennoch verspricht er: „Wir planen das aber innerhalb der nächsten drei Monate.“

Der Grundstein ist gelegt. Nun müssen die beiden Hamburger beweisen, dass sie nach dem Abitur nicht nur programmieren, sondern auch unternehmerisch durch den dichten Verkehr des Mobilitätsmarktes navigieren können.

Vom Corona-Hilfsprojekt zur Tech-Plattform: BON BON greift nach dem Gastro-Gutscheinmarkt

Wie sich das Hamburger GastroTech-Start-up BON BON der Gründer David Bernhard, Patrick Kosmala und Malte Steiert neu positioniert und mit smarten Kassen-Schnittstellen den 10-Milliarden-Gutscheinmarkt erobern will.

Steigende Kosten, kurzfristige Reservierungsabsagen und eine spürbare Konsumzurückhaltung setzen die deutsche Gastronomiebranche im Jahr 2026 massiv unter Druck. In diesem Klima positioniert sich das Hamburger GastroTech-Unternehmen BON BON mit einem Plattform- und Markenrelaunch neu. Der Plan des Start-ups: Es will sich vom reinen Gutscheinanbieter zum Technologie- und Infrastrukturpartner der Branche wandeln. Damit rückt der deutsche Gutscheinmarkt, der ein jährliches Gesamtvolumen von rund zehn Milliarden Euro aufweist, ins strategische Visier der Hanseaten.

Pandemie-Baby wird erwachsen: Der Weg ins B2B-Geschäft

Die Wurzeln von BON BON liegen in der Corona-Pandemie. Das Start-up ging aus der Solidaritäts-Initiative PayNowEatLater hervor, die 2020 als digitaler Rettungsschirm ins Leben gerufen wurde. Was als Hilfsaktion durch die vier Gründer David Bernhard, Patrick Kosmala, Niclas Störmer und Malte Steiert begann, verbindet heute gastronomische Betriebe mit Endverbraucher*innen und Firmenkund*innen.

Der Weg vom provisionsfreien Projekt zur B2B-Plattform ist jedoch ressourcenintensiv. Auf die Frage, wie dieser Sprung finanziert wurde und ob Venture Capital im Spiel war, erklärt Co-Gründer David Bernhard: „Tatsächlich konnten wir die Dynamik und den Rückenwind aus der Corona-Zeit nutzen, um die Weiterentwicklung aus eigener Kraft zu finanzieren. Dadurch ist BON BON bis heute vollständig bootstrapped und wir können unabhängig von externem Investorendruck unsere langfristige Vision verfolgen.“

Kassen-Schnittstellen: Der technische Umbau

Der strategische Kern der Neuausrichtung ist der Ausbau nativer Schnittstellen zu Kassen-Systemen (POS). Durch diese Systemintegration sollen Gutscheine automatisiert direkt am Tresen validiert und verbucht werden. Das Unternehmen gibt an, damit den administrativen Aufwand im operativen Alltag der Betriebe drastisch senken zu wollen. Die Gutscheine selbst sind deutschlandweit in über 10.000 Partner*innen-Betrieben einlösbar – von der Kiez-Gastronomie bis zur 3-Sterne-Küche.

Der Aufbau dieses Netzwerks sei laut Unternehmen ein zentraler Schritt gewesen. Rund 1.500 Gastronomien stammen noch direkt aus der Pandemie-Phase, der Rest sei organisch durch Empfehlungen, Messen und den Ausbau von Einzelbetrieben hin zu Ketten gewachsen.

Bezüglich der Abwanderungsquote im Wettbewerb verweist der Gründer auf das eigene Angebot: „Die Churn-Rate zu alternativen Angeboten ist bei uns sehr gering, da unser Leistungsversprechen und die erzielbaren, klar messbaren Ergebnisse für die Gastronomien äußerst überzeugend sind. Die häufigsten Gründe für Abgänge sind tatsächlich Insolvenzen oder Geschäftsaufgaben – bedingt durch die insgesamt herausfordernde wirtschaftliche Lage in der Gastronomie.“

Monetarisierung und Social Impact

Begleitet wird diese Entwicklung durch eine visuelle Neuausrichtung, für die das Unternehmen eine Food-Branding-Agentur engagiert hat. Zudem setzt BON BON auf eine Social-Impact-Komponente: Pro verkauftem Gutschein fließen 0,25 Euro an die Welthungerhilfe zur Finanzierung von Schulmahlzeiten in Burundi.

Hinsichtlich der Monetarisierung legt Bernhard dar, wie sich das Zwei-Säulen-Modell der Hamburger rechnet: „Hier profitieren wir stark davon, dass unser Geschäftsmodell auf zwei Säulen basiert: Zum einen unser Gutscheinsystem inklusive POS-Integrationen für Gastronomien, über das sie ihre eigenen Gutscheine verkaufen und verwalten können – wobei unsere Marge hier bewusst sehr gering ist. Der strategisch wichtigere Bestandteil ist der BON BON Universalgutschein, der bei allen Partner-Gastronomien eingelöst werden kann.“

Die Erlöse generiert das Unternehmen dabei vor allem über das Firmenkund*innengeschäft. „Einnahmen erzielen wir hier insbesondere über unsere B2B-Lösungen, etwa automatisierte Gutscheinversendungen zu Anlässen wie Geburtstagen, sowie über die branchenübliche Nichteinlösequote, die bei Gutscheinsystemen immer eine Rolle spielt“, so der Gründer weiter.

Der Kassenmarkt als operative Hürde

Der Gutschein-Sektor ist stark fragmentiert und umkämpft. Im Erlebnisbereich agieren Anbieter wie Jochen Schweizer, im Gastro-Segment Akteure wie Yovite oder subventionierte Stadtgutschein-Initiativen.

Eine wesentliche operative Hürde für BON BON liegt in der technologischen Zersplitterung der Branche. Gefragt nach der technischen Herausforderung, funktionierende Schnittstellen von Orderbird über Vectron bis Lightspeed trotz Software-Updates stabil zu halten, räumt Bernhard ein: „Das ist tatsächlich eine große Herausforderung, der wir mit sehr langfristig aufgebauten und partnerschaftlichen Beziehungen sowohl zu den Kassensystemanbietern als auch zu den Gastronom*innen begegnen. Erfreulicherweise sind die relevanten Schnittstellen dabei vergleichsweise stabil und weitgehend von den schnellen Entwicklungszyklen der eigentlichen Kassensoftware entkoppelt, was uns eine verlässliche technische Integration ermöglicht.“

Ausblick auf die kommenden Monate

Ob es dem Team langfristig gelingt, den Betrieben bürokratische Hürden im Alltag durch POS-Integrationen abzunehmen, wird der Praxis-Test zeigen. Gleichzeitig muss sich beweisen, ob die überarbeitete Website und die mobile Nutzer*innenführung ausreichen, um Endkund*innenkäufe außerhalb typischer Phasen wie Weihnachten konstant zu generieren.

Für die kommenden 12 bis 18 Monate hat das Team Produkt-Schritte definiert. Bernhard benennt die geplante Expansion: „Die Weiterentwicklung geht hier klar in zwei Richtungen: Zum einen in die kontinuierliche Erschließung weiterer Supermarktketten, zum anderen vor allem in den Ausbau erweiterter Firmenangebote rund um steuerfreie Sachbezüge. Dabei ermöglichen wir es Arbeitgebenden – unter bestimmten Voraussetzungen, die wir dank unserer Kassensystem-Integrationen zunehmend zuverlässig erfüllen – ihren Mitarbeitenden monatlich oder zu besonderen Anlässen steuerfrei Gutscheine bereitzustellen.“

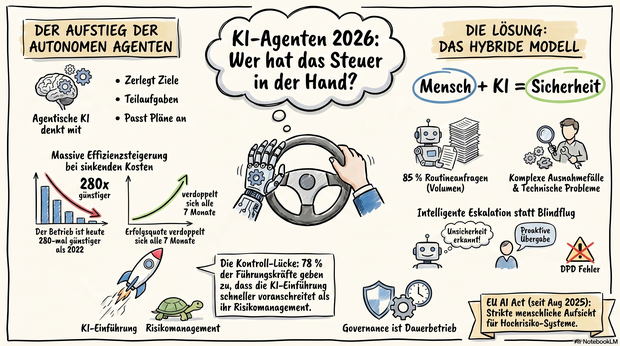

KI-Agenten auf dem Vormarsch: Warum 2026 alles von Kontrolle abhängt

Agentische KI ist das dominierende Technologiethema des Jahres 2026 – und trotzdem stehen die meisten Unternehmensverantwortlichen noch immer vor einer grundlegenden Frage: Wer hat hier eigentlich das Steuer in der Hand?

Eine EY-Umfrage vom März 2026 zeigt deutlich: 78 Prozent der befragten Führungskräfte geben zu, dass die KI-Einführung in ihren Unternehmen schneller voranschreitet, als sie die damit verbundenen Risiken beherrschen können.

Das ist kein Zufall. Im Laufe des Jahres 2025 haben viele Unternehmen den Schritt gemacht – vom Experiment hin zur skalierbaren Nutzung von KI im operativen Alltag. Die Ausgaben für generative KI sind im selben Zeitraum auf rund 37 Milliarden US-Dollar gestiegen. Doch nicht das schnelle Wachstum des KI-Ökosystems hat die Debatte in Richtung Kontrolle verschoben, sondern eine neue Generation von Systemen: agentische KI.

Was agentische KI wirklich ist – und warum 2026 ihr Jahr ist

Klassische KI-Systeme funktionieren nach einem einfachen Prinzip: Eingabe rein, Antwort raus. Agentische Systeme gehen deutlich weiter. Sie sind Plattformen oder Programme, die:

- ein übergeordnetes Ziel entgegennehmen,

- es in Teilaufgaben zerlegen,

- passende Werkzeuge auswählen,

- einen Plan eigenständig ausführen,

- und ihr Vorgehen laufend anpassen, um das gewünschte Ergebnis zu erreichen – und das alles innerhalb eines definierten betrieblichen Rahmens.

Was nach außen wie ein einzelner KI-Agent wirkt, ist in der Praxis meist ein Netzwerk spezialisierter Systeme, die jeweils einen Teil eines Workflows übernehmen und von einer Orchestrierungsebene koordiniert werden.

Gerade weil diese Systeme weitgehend autonom arbeiten, steigt ihr wirtschaftlicher Nutzen deutlich. Prozesse wie Vertriebsrecherche, Pipeline-Management oder Compliance-Prüfungen – für die früher ganze Teams nötig waren – lassen sich heute automatisieren.

Der Fortschritt ist messbar: Die Bandbreite an Aufgaben, die agentische KI mit einer Erfolgsquote von rund 80 Prozent bewältigt, verdoppelt sich etwa alle sieben Monate. Gleichzeitig sind die Kosten stark gesunken. Der Betrieb eines Systems auf dem Niveau von GPT-3.5 ist heute rund 280-mal günstiger als noch 2022. Auch Hardwarekosten sinken jährlich um etwa 30 Prozent. In diesem Tempo wird es für Unternehmen zunehmend schwer, gute Gründe gegen den Einsatz agentischer KI zu finden.

Die Governance-Lücken, über die kaum jemand spricht

Die Diskussion über Risiken konzentriert sich häufig auf das Offensichtliche: Datenlecks, Prompt Injection oder Modellschwächen. Die eigentlichen Herausforderungen liegen tiefer.

Agentische KI ist kein Projekt mit einem klaren Endpunkt. Sie ist ein laufender Betrieb, der kontinuierliche Überwachung, Anpassung und klare Verantwortlichkeiten erfordert. Genau hier liegt die Schwachstelle vieler Unternehmen: Sie behandeln KI wie ein Software-Feature – einmal einführen und dann weitermachen. Genau dort beginnen die Probleme – oft unbemerkt.

Hinzu kommt ein weiteres Risiko: Open-Source-Modelle. Wenn die zugrunde liegende Architektur beliebig verändert werden kann, wird der Datenschutz schwer kontrollierbar – besonders für Unternehmen, die mit Kund*innendaten arbeiten.

Damit verbunden ist ein grundlegendes Problem: Agentische KI ist nur so zuverlässig wie die Logik, auf der sie basiert. Wer nicht systematisch alle Grenzfälle testet, riskiert, dass das System genau dort Lücken findet und nach seiner eigenen Logik handelt – nicht im Sinne der tatsächlichen Prozesse im Unternehmen. KI ist keine Wunderwaffe. In bestimmten Fällen ist klassische Automatisierung mit fest definierten Regeln deutlich verlässlicher, wenn Prozesse zu 100 Prozent korrekt ablaufen müssen.

Wenn KI keine Wunderwaffe ist: Reale Fälle

Die beschriebenen Risiken sind längst Realität – manchmal sichtbar, manchmal kaum wahrnehmbar. Im Januar 2024 musste der Paketdienstleister DPD seinen KI-Kundenservice abschalten, nachdem ein Systemupdate die Schutzmechanismen entfernt hatte. Ein Kunde brachte den Bot dazu, zu fluchen, Gedichte über seine eigene Nutzlosigkeit zu schreiben und DPD als „schlechtesten Paketdienst der Welt“ zu bezeichnen. Das Unternehmen sprach von einem Fehler. Tatsächlich zeigte der Vorfall, was passiert, wenn KI ohne ausreichende Tests und Aufsicht eingesetzt wird. Innerhalb weniger Stunden verbreitete sich der Fall über soziale Medien und führte zu erheblichem Reputationsschaden.

In anderen Fällen bleibt das Ganze weitgehend unsichtbar. Im September 2025 berichtete Press Gazette über mehrere PR-Agenturen, die Journalist*innen systematisch mit KI-generierten Pressemitteilungen versorgten – inklusive erfundener Expert*innen. Die zitierten Personen ließen sich online nicht nachweisen, dennoch wurden Inhalte in großen Medien veröffentlicht.

Unterschiedliche Branchen, gleiche Ursache: fehlende Governance, fehlende Verantwortlichkeit und niemand, der im entscheidenden Moment die Kontrolle übernimmt.

Der hybride Ansatz: Was er ist – und was nicht

Die Antwort auf die Governance-Lücke ist nicht, die Einführung von KI zu verlangsamen. Es geht darum, KI nicht länger als Ersatz für menschliches Urteilsvermögen zu behandeln – sondern Systeme zu schaffen, in denen beide das tun, was sie am besten können.

Ein echtes hybrides Modell bedeutet, ein Setup zu schaffen, in dem KI das Volumen übernimmt – Routineanfragen, sich wiederholende Aufgaben, vorhersehbare Interaktionen – während sich menschliche Mitarbeitende auf das konzentrieren, was KI nicht zuverlässig leisten kann: komplexe Fälle und Ausnahmefälle, bei denen Ergebnisse stark von Einschätzung und Kontextverständnis abhängen.

Genauso wichtig ist, was ein hybrides Modell nicht ist. Einen Chatbot in einen bestehenden Workflow einzubinden, ist kein hybrides Modell, sondern nur ein zusätzliches Feature. Und Mitarbeitende, die KI-Ergebnisse lediglich passiv überwachen, arbeiten nicht wirklich hybrid – das ist bloße Aufsicht ohne aktive Beteiligung.

Im Alltag ist die Grenze zwischen „das lässt sich automatisieren“ und „das besser nicht“ konkreter, als die meisten Unternehmen erwarten. Ein Beispiel: ein SaaS-Unternehmen. Anfragen zu Abonnements, Kontozugängen oder Zahlungsfragen folgen vorhersehbaren Mustern, die Antworten liegen bereits vor – Kund*innen fragen oft nur, weil sie nicht selbst suchen möchten. Das sind ideale Kandidaten für Automatisierung. Entsprechend zeigen Anbieter*innen im Kundensupport, die das hybride Modell bereits getestet haben: Ein gut trainierter KI-Agent kann bis zu 85 Prozent solcher Anfragen übernehmen – mit sofortigen Antworten und ohne Einbußen bei der Kund*innenzufriedenheit.

Bei technischen Problemen sieht das anders aus. Tritt ein Fehler auf oder fällt ein Server aus, weiß oft nicht einmal das Produktteam sofort, was passiert ist – geschweige denn, wie das Problem zu lösen ist. Ein KI-Agent ohne diesen Kontext folgt seinem Training und liefert eine scheinbar sichere Antwort – und führt Kund*innen damit in die falsche Richtung. In einem kritischen Moment ist das kein kleines Ärgernis, sondern ein direkter Weg, Kund*innen dauerhaft zu verlieren. Deshalb bleiben gezielte Weiterleitungen an menschliche Mitarbeitende ein bewusstes Element – denn manche Situationen erfordern das Urteilsvermögen und die Sorgfalt, die nur ein Mensch bieten kann.

Welche Governance-Lösungen es heute schon gibt

Unternehmen, die KI-Integrationen systematisch testen, kommen zu einem klaren Ergebnis: Der wirksamste Ansatz ist, Systeme so zu gestalten, dass sie ihre eigenen Grenzen erkennen. Das bedeutet konkret: Die KI erkennt Unsicherheit, eskaliert automatisch und übergibt an Menschen, bevor Schaden entsteht.

Regulatorisch gibt es erste Leitplanken. Der EU AI Act gilt seit August 2025 vollständig und schreibt für Hochrisiko-KI-Systeme menschliche Aufsicht und Risikomanagement vor.

Doch Regeln allein reichen nicht. Sie definieren Rahmenbedingungen, aber nicht, wie konkret gehandelt werden soll, wenn eine KI auf eine Situation trifft, für die sie nicht trainiert wurde – und ein(e) Kund*in auf eine Antwort wartet.

Genau hier entscheidet sich, ob Governance funktioniert. Und genau das sollte 2026 nicht mehr dem Zufall überlassen werden.

Die Autorin Nataliia Onyshkevych ist CEO von EverHelp. Sie arbeitet mit wachsenden Unternehmen aus unterschiedlichen Branchen daran, Customer Support in KI-gestützten Umgebungen skalierbar und wirkungsvoll zu gestalten.

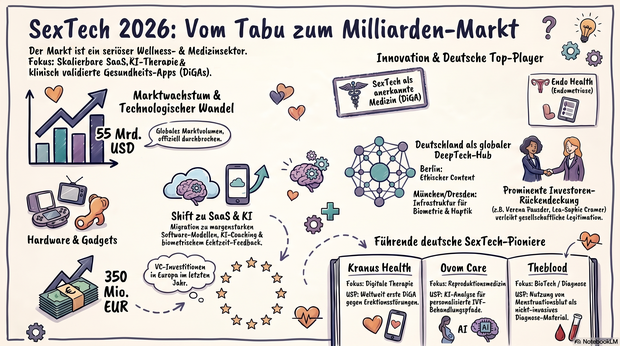

SexTech-Start-up-Report 2026

Vom Tabu zum 55-Milliarden-Markt: Wie KI und DeepTech die digitale Intimität revolutionieren und wer die führenden deutschen Start-ups in diesem Segment sind.

Noch vor wenigen Jahren reichte ein einfaches Erwähnen des Begriffs aus, um in gediegenen Investor*innenrunden für betretenes Schweigen oder nervöses Räuspern zu sorgen. Doch ist die Schmuddelecke von gestern einer der vielleicht spannendsten und margenstärksten Wachstumsmärkte von heute.

Wer als erfahrene(r) Wagniskapitalgeber*in den Aufstieg von FemTech und die Enttabuisierung von DeathTech aufmerksam verfolgt hat, weiß: Digitale Intimität ist der nächste logische, Milliarden schwere Schritt. SexTech hat sich als hochprofessioneller Wellness-Sektor etabliert, der menschliche Grundbedürfnisse mit DeepTech, künstlicher Intelligenz und medizinischer Präzision verknüpft.

Die Marktlage: Wenn Algorithmen die Intimität skalieren

Der globale Markt für sexuelles Wohlbefinden hat im Jahr 2026 die prognostizierte Marke von 55 Milliarden US-Dollar durchbrochen. Europa spielt dabei eine zentrale Rolle. Aktuelle Datenbank-Auswertungen belegen einen historischen Wendepunkt: Allein im vergangenen Jahr flossen weit über 350 Millionen Euro europäisches Risikokapital in Start-ups aus dem Bereich der sexuellen Gesundheit.

KI fungiert längst nicht mehr nur als Spielerei, sondern als Motor für hyperpersonalisierte Paartherapie-Bots, biometrisches Feedback in Echtzeit und empathische Begleitsysteme. Der Markt ist von reinen Hardware-Gadgets hin zu margenstarken Software-as-a-Service-Modellen migriert, was die Skalierbarkeit drastisch erhöht.

Reality Check: Die harten Fallstricke

Trotz des Hypes ist der Weg zum Exit gnadenlos. Das Scheitern von Pionieren hat gezeigt: Wer Hardware ohne Margen-Kontrolle baut oder die Datensicherheit vernachlässigt, scheitert sofort. Zudem bleiben „Vice Clauses“ bei Zahlungsdienstleistern und das algorithmische Shadowbanning auf Social-Media-Plattformen die größten Hürden. Wer hier skalieren will, muss die Community organisch binden.

Das deutsche Netzwerk: Die Hubs der Innovation

Deutschland hat sich global stark positioniert:

- Berlin: Das kulturelle Epizentrum für B2C-Plattformen und ethischen Content.

- München: Die DeepTech-Schmiede für biometrische Sensoren und Medizintechnik.

- Hamburg: Hub für Content-getriebene Marktplätze und E-Commerce-Expertise.

- Dresden/Leipzig: Aufstrebende Zentren für Haptik-Software und B2B-Infrastruktur.

Investor*innen-Radar: Wer das Tabu finanziert

Die Investor*innenlandschaft hat sich diversifiziert. Während spezialisierte VCs wie Amboy Street Ventures den Weg ebneten, investieren heute Generalisten wie Cherry Ventures oder HV Capital offen unter dem Label „Digital Health“. Den wichtigsten Treibstoff liefern jedoch Business Angels: Prominente Köpfe wie Verena Pausder und Lea-Sophie Cramer fungieren nicht nur als Kapitalgeber*innen, sondern als PR-Schutzschilde, die dem Thema gesellschaftliche Legitimation verleihen.

Die Top 10 Start-ups (Must-Watch 2026)

Die Auswahl der Top 10 basiert auf einer Analyse des Marktes im Mai 2026. Bewertet wurden Marktrelevanz, technologischer Reifegrad (AI/DeepTech), Diversität im Gründerteam und das Vertrauen namhafter Lead-Investor*innen. Es wurden ausschließlich Start-ups aufgenommen, die ab dem Jahr 2020 gegründet wurden, um den aktuellen Innovationszyklus abzubilden.

Cheex

Das Berliner Start-up wurde 2020 von Denise Kratzenberg und Maximilian Horwitz gegründet und ist heute der Leuchtturm für ethischen Content. Mit einem Subscription-Modell bietet Cheex Filme und Audios an, die Diversität und Konsens fokussieren. Anstatt klassischer VCs bewiesen hier starke Business-Angel-Syndikate und Netzwerke wie Collective Ventures früh massives Vertrauen.

Recoupling

Gegründet 2021 in Berlin von Jaane Henning, Tom Haubner und Johanna Lubig (welche heute jedoch operativ nicht mehr aktiv ist), nutzt die App psychologisch fundierte, KI-gesteuerte Coaching-Pfade, um die Kommunikation bei Paaren zu verbessern. Der technologische Kern analysiert Beziehungsmuster und erkennt Frühwarnsignale für Entfremdung. Recoupling sicherte sich Kapital namhafter Tech-Angels wie Bernd Heinrichs und Ingo Weber.

Bloom Stories

Das 2020 von Michael und Hannah Albertshauser gestartete Bloom Stories beweist die Macht von Audio-First-Erotik. Der USP ist die tiefe Immersion: Bloom Stories integrierte KI-Chatbots und bietet eine direkte Schnittstelle zu smarten Toys (wie Lovense), die ihre Vibration exakt an die Handlung der Audiospuren anpassen.

Kranus Health

Gegründet 2020 von Jens Nörtershäuser und Thilo Kleinschmidt, ist Kranus Health der Vorreiter für digitale Gesundheitsanwendungen (DiGA). Ihre App Kranus Edera ist die weltweit erste erstattungsfähige digitale Therapie gegen Erektionsstörungen. Top-Investor*innen wie der High-Tech Gründerfonds (HTGF) und Karista investierten früh Millionen in diesen medizinischen Ansatz.

Hapticlabs

Das 2021 in Dresden gegründete B2B-SaaS-Unternehmen (ein Spin-off der TU Dresden) Hapticlabs liefert Hersteller*innen ein „No-Code Haptics“-Toolkit. Entwickler*innen können damit komplexes Vibrationsfeedback für Hardware visuell programmieren. Diese essenzielle Infrastruktur für die nächste Generation von Intimprodukten zog früh DeepTech-Investor*innen an.

Frieda Health

Die 2022 von Valentina Ullrich in Hamburg gegründete Plattform Frieda Health besetzt das Segment „Silver Intimacy“. Frieda bietet eine digitale Telemedizin-Plattform für Frauen in der Menopause. Das enorme Potenzial erkannte der Maximon Longevity Co-Investment Fund, der die millionenschwere Pre-Seed-Runde anführte und die Brücke zum Megatrend Langlebigkeit schlug.

Ovom Care

Das 2023 in Berlin gegründete Start-up von Felicia von Reden, Dr. Lynae Brayboy und Dr. Cristina Hickman nutzt Machine Learning, um die Reproduktionsmedizin zu revolutionieren. Die Software analysiert klinische Daten für personalisierte IVF-Behandlungspfade. Investor*innen wie Alpha Intelligence Capital und Merantix unterstützen diesen DeepTech-Ansatz von Ovom Care massiv.

Endo Health

Das 2020 von der Ärztin Dr. med. Nadine Rohloff und Markus Rothenhöfer in Chemnitz und Berlin gegründete Endo Health adressiert eine der größten Versorgungslücken in der Frauengesundheit: Endometriose. Seit Januar 2026 ist die Endo-App als dauerhaft gelistete DiGA (Digitale Gesundheitsanwendung) anerkannt. Der technologische Kern der App kombiniert multimodale Schmerztherapie, physiotherapeutische Übungen und KI-gestütztes Symptom-Tracking. Durch die volle Erstattungsfähigkeit durch die Krankenkassen und die klinische Validierung ist Endo Health ein Musterbeispiel für die Transformation von SexTech hin zu evidenzbasierter Digital-Medizin.

Theblood

Dieses 2022 von Isabelle Guenou und Miriam Santer in Berlin gegründete BioTech-Projekt Theblood nutzt Menstruationsblut als nicht-invasives Diagnose-Material. Das Team wird durch RoX Health (das Accelerator-Studio von Roche) unterstützt, um hormonelle Dysbalancen und Biomarker systematisch auszuwerten.

Nevernot

Das 2020 von Anna Kössel und Katharina Trebitsch gegründete Start-up Nevernot skaliert durch Meisterschaft im digitalen Community-Building. Ursprünglich bekannt für Soft-Tampons, ist nevernot heute eine holistische Intim-Care-Plattform. Zu den Investoren zählen Branchengrößen wie Verena Pausder und Lea-Sophie Cramer.

Internationaler Ausblick & Fazit

Während Europa auf ethischen Content und Datenschutz setzt, formen Makro-Trends aus Übersee die nächste Stufe. Aus den USA schwappt die Neuro-Modulation herüber, in Asien beobachten wir die Perfektionierung emotionaler KI-Avatare, und Israel zementiert seinen Ruf durch Biotech-Start-ups, die sexuelle Dysfunktionen auf zellulärer Ebene behandeln.

Der Markt verzeiht keine unprofessionellen Bastellösungen mehr. Wer skalieren will, muss die Regulierungsbehörden genauso ernst nehmen wie die Endkunden. Für Investoren ist die Botschaft klar: Die Schamgrenze an der Tür zum Investmentkomitee stehen zu lassen, ist keine Frage der moralischen Offenheit, sondern schlichtweg harte finanzielle Pflicht. Wer diesen Sektor ignoriert, verpasst die lukrativste Schnittmenge aus Health, KI und menschlicher Natur.

Die digitale Infrastruktur-Hürde: Auffällig im Jahr 2026: Die Professionalisierung führt zu neuen Reibungspunkten. Dass Portale wie Cheex oft durch ISP-Filter blockiert werden oder theblood ihre Webpräsenz für klinische Zertifizierungsphasen (SGS-Kooperation) komplett umbauen, ist kein Zeichen von Schwäche, sondern ein Symptom der extremen regulatorischen Dichte. Der Markt ist erwachsen geworden – und mit ihm die Hürden für Sicherheit, Altersprüfung und klinische Evidenz.

Wer 2026 skalieren will, muss Regulatorik genauso ernst nehmen wie das Produkt. Investor*innen haben längst erkannt: SexTech ist kein moralisches Wagnis, sondern eine harte finanzielle Pflicht an der Schnittstelle von Health, KI und menschlicher Natur. Wer die „Website-Stille“ der klinischen Launch-Phasen als Scheitern deutet, verkennt die neue Ernsthaftigkeit einer Branche, die sich anschickt, das Gesundheitswesen dauerhaft zu verändern.

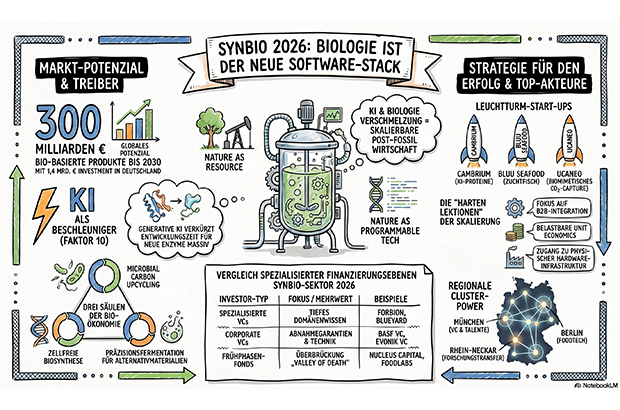

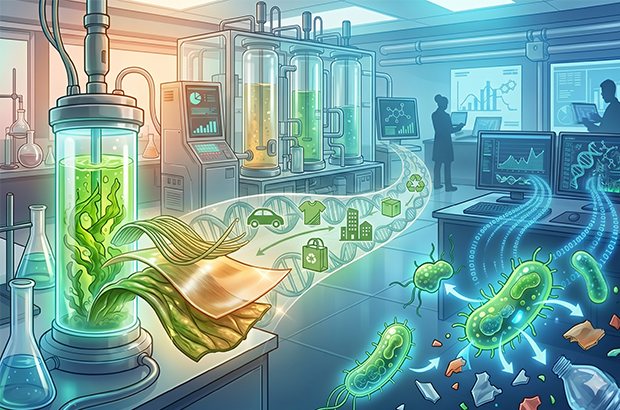

SynBio-Start-up-Report 2026

Biologie ist der neue Code: Wie Synthetische Biologie (SynBio) die Industrie neu programmiert und welche Start-ups dabei hierzulande federführend sind.

Die Vision einer post-fossilen Wirtschaft ist im Jahr 2026 keine bloße Utopie mehr, sondern eine präzise Ingenieursleistung. Wir erleben den Moment, in dem die Natur von einer Ressource, die wir ausbeuten, zu einer Technologie wird, die wir programmieren. In den Laboren der Republik entstehen heute Lösungen für die größten Versorgungskrisen unserer Zeit. Der Aufstieg der Synthetischen Biologie (SynBio) markiert den Übergang vom Zeitalter der Petrochemie in das Zeitalter der Biomanufaktur – eine Transformation, die so tiefgreifend ist wie die industrielle Revolution, jedoch mit der Geschwindigkeit der digitalen Transformation erfolgt.

Wenn Bits auf Atome treffen

Der SynBio-Markt ist 2026 in eine Phase der industriellen Skalierung eingetreten. Aktuelle Analysen der KfW sowie Branchenberichte von BCG beziffern das globale Marktpotenzial für bio-basierte Produkte bis Ende des Jahrzehnts auf über 300 Milliarden Euro. Allein in Deutschland ist das Investitionsvolumen in DeepTech-BioTech-Start-ups im vergangenen Geschäftsjahr laut Bitkom-Daten auf einen Rekordwert von 1,4 Milliarden Euro gestiegen. Der entscheidende technologische Katalysator ist die Verschmelzung von Generativer KI und Biologie. Dank Modellen, die Proteinfaltungen präziser vorhersagen können, als es je ein menschlicher Forscher vermochte, wurde die Entwicklungszeit für neue Enzyme um den Faktor zehn verkürzt. Die Biologie wird damit endgültig zum „Software-Stack“, bei dem Design-Build-Test-Learn-Zyklen in digitalisierten Bio-Gießereien automatisiert ablaufen.

Jenseits der Petrischale: Die Treiber der Bio-Ökonomie

Drei spezifische Sub-Sektoren dominieren in diesem Jahr die Agenda der Investor*innen. An erster Stelle steht die zellfreie Biosynthese, bei der komplexe Moleküle ohne den Einsatz lebender Zellen produziert werden, was die Skalierbarkeit massiv erhöht. Pioniere wie das US-Unternehmen Solugen haben hier den Weg geebnet, doch deutsche Akteure ziehen in der Effizienz der Bioreaktor-Steuerung nach. Ein zweiter massiver Treiber ist das Microbial Carbon Upcycling: Mikroben werden so programmiert, dass sie industrielles CO2 direkt in hochwertige Proteine oder Kunststoffe umwandeln. Hier verschmelzen Klimaschutz und Produktion zu einer Einheit. Drittens sehen wir den Siegeszug der Biomanufaktur bei Alternativmaterialien – sei es durch Biomasse-Fermentation für Lederersatz aus Myzel oder durch echte Präzisionsfermentation, bei der etablierte Akteure wie die bayrische AMSilk zeigen, dass programmierte Spinnenseide-Proteine bereits in Serie gehen können. Die Lieferkette der Mode- und Automobilindustrie wird durch diese Biopolymere radikal dekarbonisiert.

Die harten Lektionen der Skalierung

Der Weg zum Erfolg war jedoch von schmerzhaften Rückschlägen gepflastert. Der prominente Crash des einstigen Branchenlieblings Amyris im Jahr 2023 wirkt bis heute als warnendes Beispiel nach. Das Unternehmen scheiterte trotz Milliardenbewertung an der Komplexität der vertikalen Integration und dem Versuch, gleichzeitig Technologieplattform und B2C-Marke zu sein. Für heutige Gründer*innen haben sich daraus vier fatale Fallstricke herauskristallisiert, die über Sieg oder Niederlage entscheiden. Erstens: Die Ignoranz gegenüber den Unit Economics. Ein Produkt, das im 5-Liter-Maßstab funktioniert, muss im 50.000-Liter-Kessel nicht zwangsläufig profitabel sein. Zweitens: Das „Regulatorik-Vakuum“. Wer die EU-Novel-Food-Verordnungen oder GVO-Richtlinien nicht von Tag eins an in die Produktentwicklung einplant, riskiert Jahre des Stillstands. Drittens: Die Fokussierung auf den Endkonsument*innen statt auf B2B-Integration. Der wahre Hebel liegt in der Lizenzierung von Prozessen an die Industrie. Viertens: Die Unterschätzung der Hardware-Komponente. SynBio ist kein reines Software-Business; ohne Zugang zu physischer Infrastruktur bleibt jede Innovation im Labor gefangen.

Deutschlands Bio-Cluster

Deutschland hat sich im internationalen Vergleich als einer der stärksten Hubs für SynBio etabliert, getrieben durch eine einzigartige Verzahnung von Spitzenforschung und industrieller Basis. In München und dem angeschlossenen IZB Martinsried konzentriert sich die größte Dichte an Venture Capital und Talenten, eng flankiert durch die Exzellenz-Cluster der TU München. Berlin hat sich durch spezialisierte Inkubatoren wie den ProVeg Incubator, Atlantic Food Labs (FoodLabs) und den Science Park Berlin-Buch zum absoluten Zentrum für FoodTech und zelluläre Landwirtschaft entwickelt. Ein weiterer Hotspot ist das Rhein-Neckar-Delta rund um Heidelberg, wo das European Molecular Biology Laboratory (EMBL) und der BioRN-Cluster eine Brücke zwischen Grundlagenforschung und Marktreife schlagen. Aachen punktet mit der RWTH und einer starken Fokussierung auf Bio-Verfahrenstechnik, während der Raum Darmstadt/Frankfurt durch die Nähe zu Giganten wie Merck und die TU Darmstadt als Kraftzentrum für die industrielle Bioproduktion gilt.

Investor*innen-Radar

Die Finanzierungslandschaft hat sich spezialisiert. Wir unterscheiden im Jahr 2026 vier Ebenen der Kapitalgeber*innen. Die spezialisierten VCs wie Forbion, BlueYard Capital oder Sofinnova Partners bringen das notwendige tiefe Domänenwissen mit. Auf der zweiten Ebene stehen Top-Tier Generalisten wie HV Capital und Earlybird, die SynBio zunehmend als Teil ihrer Dekarbonisierungs-Strategie begreifen. Besonders kritisch für die Skalierung sind die Corporate VCs der Industrie, allen voran BASF Venture Capital und Evonik Venture Capital, die nicht nur Geld, sondern auch Abnahmegarantien und technisches Know-how bieten. In der Frühphase bewegen zudem spezialisierte Mikro-Fonds wie Nucleus Capital oder erfahrene ClimateTech-Angels den Markt, oft organisiert in Syndikaten, die das „Valley of Death“ zwischen Labor und Prototyp überbrücken

Die Top-Start-ups: Unsere Must-Watch-Liste 2026

Für die folgende Auswahl der Start-ups haben wir Unternehmen analysiert, die nach 2019 in Deutschland gegründet wurden. Die Auswahlkriterien basieren auf der technologischen Tiefe (IP-Portfolio), dem Reifegrad der Pilotierung, der Validierung durch renommierte Investoren sowie dem Potenzial, bestehende industrielle Lieferketten systemisch zu verändern. Diversität in Gründungsteams und die Skalierbarkeit der zugrunde liegenden Bio-Plattform waren weitere entscheidende Faktoren.

- Cambrium (Berlin, gegründet 2020): Das Team um Dr. Mitchell Duffy nutzt eine KI-gestützte Designplattform, um neuartige Proteine mit molekularen Funktionen zu entwickeln, die in der Natur so nicht vorkommen. Ihr Fokus liegt auf der Kosmetik- und Textilindustrie, wo sie petrochemische Inhaltsstoffe durch bio-designte Alternativen ersetzen. Mit massiven Finanzierungsrunden, angeführt von Tech-Schwergewichten wie Essential Capital und dem Google-KI-Fonds Gradient Ventures, gilt Cambrium als Leuchtturm für eine neue Generation von Biomaterial-Zulieferern, die aus digitalem Code physische Hochleistungsprodukte erschaffen.

- Bluu Seafood (Berlin, gegründet 2020): Gegründet von Dr. Sebastian Rakers und Simon Fabich, ist Bluu einer der führenden europäischen Akteure im Bereich kultivierter Fisch. Durch die Kultivierung echter Fischzellen im Bioreaktor adressieren sie die Überfischung der Meere. Nach signifikanten Investments durch Lead-Investor Sparkfood sowie LBBW VC und Delivery Hero Ventures steht das Unternehmen kurz vor der ersten Marktzulassung in Singapur und den USA.

- Colipi (Hamburg, gegründet 2022): Das Spin-off der TU Hamburg, geführt von Maximilian Webers, nutzt eine patentierte Gasfermentationstechnologie, um CO2 in nachhaltige Öle und Lipide umzuwandeln. Der USP von Colipi ist die Nutzung von industriellen Abgasströmen als Rohstoff, was die Produktion extrem kosteneffizient macht. Sie konnten sich frühzeitig die Unterstützung von Top-Investoren wie dem High-Tech Gründerfonds (HTGF) und dem Innovationsstarter Fonds Hamburg sichern.

- Kynda (Jelmstorf, gegründet 2019): Ursprünglich als Keen 4 Greens von Daniel MacGowan-von Holstein und Franziskus Schnabel gegründet, bietet Kynda Plug-and-Play-Fermentationssysteme für die Lebensmittelindustrie an. Als B2B-Technologiepartner stellen sie modulare Bioreaktoren und Pilzkulturen bereit, mit denen Hersteller ihre eigenen Produktionsabfälle direkt vor Ort kostengünstig in Mykoproteine umwandeln können. Eine kürzliche 3-Millionen-Euro-Seed-Finanzierung – angeführt vom VC EnjoyVenture und massiv flankiert durch ein strategisches Investment des Geflügel-Giganten PHW-Gruppe – unterstreicht das enorme Skalierungspotenzial dieses Kreislauf-Modells.

- Nosh.bio (Berlin, gegründet 2022): Das Team um Tim Fronzek nutzt Pilzbiomasse als funktionalen Inhaltsstoff für die Lebensmittelindustrie, um Clean-Label-Produkte ohne Zusatzstoffe zu ermöglichen. Der technologische Vorsprung von Nosh.bio liegt in der Geschwindigkeit des Fermentationsprozesses. Frühphasen-Finanzierungen durch Earlybird unterstreichen das hohe Vertrauen in das Skalierungspotenzial.

- Ucaneo (Berlin, gegründet 2022): Das Team um Florian Tiller und Carla Glassl beweist, dass Synthetische Biologie auch beim Direct Air Capture (DAC) den Unterschied macht. Statt energieintensiver chemischer Filter nutzt Ucaneo eine biomimetische Technologie: Sie setzen das Enzym Carboanhydrase ein – eines der schnellsten Enzyme der Natur –, um CO2 bei Raumtemperatur direkt aus der Umgebungsluft zu binden. Mit starken Frühphasen-Finanzierungen durch DeepTech-Fonds wie Nucleus Capital und der US-amerikanischen Grantham Foundation baut Ucaneo derzeit in Berlin-Marienfelde ihre erste industrielle Testanlage auf.

- Insempra (München, gegründet 2021): Das Team um Gründer Jens Klein hat sich zum Ziel gesetzt, die massive Abhängigkeit der globalen Lieferketten von der Petrochemie zu beenden. Über ihre B2B-Technologieplattform nutzen sie Präzisionsfermentation, um maßgeschneiderte Inhaltsstoffe für die Kosmetik-, Lebensmittel- und Textilbranche quasi zu programmieren – von bio-basierten Lipiden und Aromen bis hin zu neuartigen Proteinfasern. Eine hochkarätige Finanzierungsrunde, angeführt von europäischen DeepTech-Schwergewichten wie EQT Ventures und BlueYard Capital, unterstreicht den Anspruch von Insempra, ein globaler industrieller Zulieferer der nächsten Generation zu werden.

Ausblick & Fazit: Der globale Wettlauf

Der Blick über den Tellerrand zeigt: Wir stehen in einem globalen Systemwettbewerb. In den USA treibt die per Executive Order erlassene „National Biotechnology and Biomanufacturing Initiative“ Milliardeninvestitionen in die heimische Infrastruktur, flankiert von Pionieren, die dort und in Frankreich (wie Biomemory) bereits an der Verschmelzung von SynBio und DNA-Datenspeicherung arbeiten. In Asien, insbesondere in China und Singapur, werden derweil regulatorische Hürden in Rekordzeit abgebaut, um die Marktführerschaft bei der Biomanufaktur zu übernehmen. Flankiert wird dies von Hubs wie Israel, die mit massivem VC-Kapital den globalen Markt für kultivierte Proteine dominieren wollen.

Das Fazit für das Jahr 2026: Biologie ist die Infrastruktur der Zukunft. Für Gründer*innen bedeutet dies, dass die Zeit der reinen Plattform-Versprechen vorbei ist; gefragt sind konkrete Produkte und belastbare Unit Economics. Für Investor*innen bietet SynBio die seltene Chance, echte „Impact-Rendite“ zu erzielen, indem sie Industrien transformieren, die über Jahrzehnte festgefahren waren. Wer heute den Code der Natur versteht und skalieren kann, wird die Welt von morgen nicht nur verstehen, sondern neu bauen.

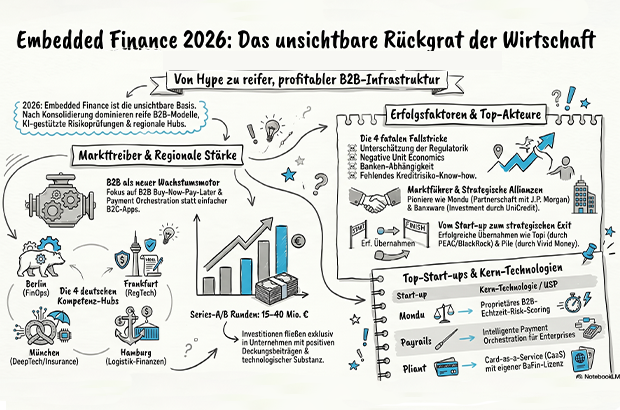

Embedded-Finance-Start-up-Report 2026

Der unsichtbare Bankensektor: Wie Embedded Finance und die dazugehörigen Start-ups die Wirtschaft des Jahres 2026 prägen.

Einst war es das große Versprechen für eine Handvoll hipper Neobanken, heute ist es das unsichtbare Rückgrat der europäischen Wirtschaft: Embedded Finance. Im Jahr 2026 wird das Marktwachstum längst nicht mehr von der fixen Idee isolierter Bank-Apps dominiert, denn jedes zukunftsorientierte Unternehmen ist mittlerweile selbst zu einem/einer Finanzdienstleister*in geworden. Ob Software-as-a-Service-Anbieter*in, Logistik-Plattform oder Marktplatz – die nahtlose Integration von Zahlungen, Krediten und Versicherungen in nicht-finanzielle Kund*innenreisen ist das neue Paradigma.

Dieser Report beleuchtet eine Branche, die den „Sturm der Konsolidierung“ überlebt hat und nun mit reifen Geschäftsmodellen und echten Profiten die Architektur der modernen Wirtschaft neu programmiert.

Vom Hype zur fundamentalen Reife

Nach den massiven Zinsanpassungen und regulatorischen Aufräumarbeiten der Jahre 2023 und 2024 zeichnet der Embedded-Finance-Markt heute ein Bild robuster Reife. Renommierte Analystenhäuser wie Bain & Company und Dealroom haben diese Entwicklung früh vorgezeichnet: Der globale Markt für Embedded-Finance-Dienstleistungen hat sich in ein Multimilliarden-Segment verwandelt, dessen europäisches Transaktionsvolumen mittlerweile signifikante Teile des digitalen B2B- und B2C-Handels stützt. Der technologische Haupttreiber dieser neuen Ära ist unbestreitbar die künstliche Intelligenz, genauer gesagt proprietäre Machine-Learning-Modelle, die Risikobewertungen in Millisekunden durchführen und Transaktionsströme dynamisch optimieren. Investor*innen honorieren diese technologische Tiefe: Wir sehen heute höchst realistische Series-A- und Series-B-Runden im Bereich von 15 bis 40 Millionen Euro für Start-ups, die nachweislich positive Deckungsbeiträge aufweisen. Es fließt wieder signifikant Kapital, doch es fließt exklusiv in Substanz und Skalierbarkeit, nicht mehr in reines Marketing.

Die neuen Treiber: B2B, Vertikalisierung und Orchestrierung

Wenn man über das Offensichtliche wie einfache White-Label-Kreditkarten hinausblickt, dominieren im Jahr 2026 drei spezifische Sub-Sektoren den Markt. Allen voran steht B2B Buy-Now-Pay-Later, eine Disziplin, die das traditionelle, schwerfällige Factoring abgelöst hat und nun direkt in B2B-Checkouts und Beschaffungsnetzwerke integriert ist. Ein weiterer massiver Treiber ist die sogenannte Payment Orchestration für vertikale SaaS-Lösungen. Hier werden komplexe, branchenspezifische Zahlungsflüsse – etwa im Handwerk oder in der Gastronomie – automatisiert im Hintergrund abgewickelt. Zuletzt etabliert sich Embedded Insurance zunehmend im Industriekontext, wo Maschinen nicht mehr nur geleast, sondern im selben Atemzug transaktionsbasiert versichert werden. Pioniere wie die Berliner Mondu oder auch europäische Schwergewichte wie Swan haben den Weg für diese hochspezialisierten Infrastruktur-Layer geebnet und gezeigt, wie tiefgreifend diese Geschäftsmodelle in die Wertschöpfungsketten der Realwirtschaft eingreifen.

Die Lektionen der BaaS-Krise

Doch dieser Reifegrad wurde teuer erkauft. Der Beinahe-Kollaps des britischen Banking-as-a-Service-Pioniers Railsr und die drastischen BaFin-Sonderprüfungen samt Wachstumsbeschränkungen bei etablierten deutschen Playern wie Solaris in den Jahren zuvor haben den Markt fundamental erschüttert. Der Traum, Finanzdienstleistungen wie einfache Legosteine zusammenzustecken, kollidierte brutal mit der harten Realität des Bankwesens.

Aus diesen gescheiterten Hoffnungen lassen sich für heutige Gründer*innen vier konkrete, fatale Fallstricke ableiten. Der erste und wichtigste ist die eklatante Unterschätzung der Regulatorik; Compliance lässt sich nicht auslagern, und Aufsichtsbehörden dulden keine agilen Versuch-und-Irrtum-Prozesse bei der Geldwäscheprävention. Der zweite Fallstrick ist die Falle der negativen Unit Economics im B2C-Sektor, wo exorbitante Kund*innenakquisitionskosten oft nur durch kontinuierliches VC-Geld gedeckt wurden. Drittens das Klumpenrisiko der Abhängigkeit von einer einzigen Partnerbank, deren Ausfall das eigene Start-up über Nacht handlungsunfähig macht. Und viertens die Fehlannahme, dass Technologie allein ausreicht; wer heute kein tiefes Verständnis für klassisches Bilanzstruktur- und Kreditrisikomanagement mitbringt, scheitert unweigerlich.

Das deutsche Netzwerk: Die Schmieden der Infrastruktur

Deutschland hat sich in dieser Konsolidierungsphase als einer der resilientesten Standorte in Europa bewiesen, getragen von vier essenziellen Hubs. Berlin verteidigt dabei seinen Status als unangefochtene Hauptstadt für FinOps und B2B-Zahlungsinfrastruktur, massiv befeuert durch die Talent-Pipelines der TU Berlin sowie das dichte Netzwerk an Serial Entrepreneurs aus der N26- und SumUp-Schule. Frankfurt am Main bildet den unverzichtbaren regulatorischen Gegenpol; hier, im Schatten von EZB und BaFin, entstehen im Umfeld des TechQuartiers und der Frankfurt School of Finance and Management jene Start-ups, die komplexe Compliance- und Treasury-Architekturen für Großbanken bauen. München dominiert den Bereich DeepTech und Embedded Insurance im industriellen B2B-Kontext, was auf die herausragende Stellung des Center for Digital Technology and Management (CDTM) und die enge Verzahnung mit der ansässigen Versicherungs- und Automobilindustrie zurückzuführen ist. Hamburg schließlich hat sich als europäischer Hotspot für Trade Finance und in Logistikketten eingebettete Finanzierungen etabliert, gestützt durch die traditionelle Stärke der Hansestadt im globalen Handel.

Investor*innen-Radar

Das Ökosystem der Geldgeber*innen hat sich im Jahr 2026 stark differenziert und professionalisiert. An der Spitze der spezialisierten VCs agieren Fonds wie FinTech Collective und Motive Ventures (hervorgegangen aus der Übernahme des Berliner VCs embedded/capital), die mit tiefem technologischen Verständnis gezielt in Infrastruktur-Layer investieren. Unter den Top-Tier Generalisten ragen Cherry Ventures, Earlybird und Point Nine heraus, die insbesondere Series-A-Runden bei überzeugenden B2B-SaaS-Modellen anführen.

Ein starker Motor sind zudem Corporate VCs und bankennahe Fonds geworden: CommerzVentures, als unabhängiger Player, treibt Themen wie Climate-Fintech massiv voran, während CVCs der Realwirtschaft wie Allianz X und Porsche Ventures strategisch in Start-ups investieren, die sich nahtlos in ihre eigenen vertikalen Ökosysteme einklinken lassen. In der kritischen Frühphase wird der Markt von einer hochgradig vernetzten Gruppe aus Business Angels angetrieben, die nicht nur erstes Kapital, sondern vor allem regulatorisches Know-how und entscheidende Bankennetzwerke einbringen

Die Top Start-ups (Must-Watch)

Für die nachfolgende Liste der Must-Watch-Unternehmen haben wir strikte Kriterien angelegt. Die Auswahl basiert auf nachgewiesener Marktrelevanz durch echte Kund*innenimplementierungen, einem hohen technologischen Reifegrad und einem diversifizierten Ansatz bei der Lösung komplexer Finanzinfrastrukturprobleme. Zudem war ein nachhaltiges Investoren-Vertrauen in den letzten zwölf Monaten ein Schlüsselfaktor. Wir beleuchten hierbei ausschließlich Start-ups mit Hauptsitz in Deutschland, deren Gründung im Jahr 2020 oder später erfolgte, um die wahre nächste Generation der Branche abzubilden.

Banxware

Das 2020 von Miriam Wohlfarth und Jens Röhrborn gegründete Banxware hat sich als Marktführer für Embedded Lending in Deutschland etabliert. Banxware bietet eine White-Label-Lösung, mit der Marktplätze und Zahlungsdienstleister*innen ihren Händler*innen Sofortkredite basierend auf historischen Umsatzdaten anbieten können. Der USP liegt in der extrem schnellen Risikoprüfung und der nahtlosen API-Integration in bestehende Plattformen. Das enorme Vertrauen der Finanzbranche in dieses Modell spiegelt sich massiv auf Investor*innenseite wider: Neben frühen Leadern wie Element Ventures (heute 13books Capital) ist insbesondere der Einstieg der Großbank UniCredit ein Ritterschlag. Die Bank führte nicht nur die Series-A-Runde an, sondern legte Mitte 2025 mit einem weiteren strategischen Millionen-Investment nach, um die europäische Expansion von Banxware gemeinsam voranzutreiben.

Pliant

Im Jahr 2020 von Malte Rau und Fabian Terner aus der Taufe gehoben, definiert Pliant den Markt für B2B-Kreditkarten und Ausgabenmanagement neu. Das B2B-SaaS-Modell kombiniert eine moderne Karteninfrastruktur mit einer tiefen API-basierten Integration in Buchhaltungs- und ERP-Systeme. Der technologische Vorsprung liegt im eigenen Card-as-a-Service-Angebot (CaaS), das anderen B2B-Plattformen den Launch eigener Kreditkartenprogramme ermöglicht. Ein entscheidender Meilenstein war hierfür der Erhalt der eigenen E-Geld-Lizenz der BaFin, die Pliant die nötige regulatorische Unabhängigkeit verleiht. Unterstützt wird Pliant von namhaften Investoren wie SBI Investment, Alstin Capital – und einem Investment des globalen Schwergewichts PayPal Ventures, das das enorme Skalierungspotenzial der Plattform bestätigt.

Mondu

Die Serial Entrepreneurs Malte Huffmann, Philipp Povel und Gil Danziger gründeten Mondu 2021 und revolutionieren damit den B2B-Zahlungsverkehr. Ihr B2B-BNPL-Modell ermöglicht es Geschäftskund*innen, online wie B2C-Kund*innen auf Rechnung oder in Raten zu kaufen, während der Händler sofort sein Geld erhält. Die Kerntechnologie ist ein proprietäres Echtzeit-Risk-Scoring für Firmenkund*innen. Finanziert wurde diese Vision anfangs von Top-Tier-Fonds wie Valar Ventures und Cherry Ventures. Der ultimative Ritterschlag erfolgte jedoch Ende 2025: Neben dem Erhalt der E-Geld-Lizenz sicherte sich Mondu eine 100-Millionen-Euro-Fazilität von J.P. Morgan Payments inklusive einer strategischen Partnerschaft, um die Buy-Now-Pay-Later-Lösung dem europäischen Kund*innen stamm der US-Großbank anzubieten.

Payrails

Gegründet 2021 von Orkhan Abdullayev, Emre Talay und Nicolas Thouzeau, löst Payrails die Herausforderung der Payment Orchestration. Das FinOps-Start-up baut ein intelligentes Betriebssystem für Zahlungen, das Transaktionen für Enterprise-Kund*innen dynamisch über verschiedene Provider routet, um Kosten zu senken und Autorisierungsraten zu maximieren. Die technologische Brillanz dieser Architektur lockte früh Schwergewichte wie Andreessen Horowitz und EQT Ventures an. Im Sommer 2025 zündete Payrails die nächste Stufe: HV Capital führte eine massive Series-A-Runde über 32 Millionen US-Dollar an, bei der auch alle Top-Tier-Altinvestoren erneut mitzogen, um die globale Expansion der Plattform endgültig zu sichern.

Finmid

Die beiden N26-Alumni Max Schertel und Alexander Talkanitsa starteten Finmid 2021 mit der Mission, jede B2B-Plattform zu einer Finanzierungsquelle zu machen. Ihr Geschäftsmodell fokussiert sich auf Embedded B2B Lending, das speziell auf die Anforderungen von Marktplätzen (wie etwa dem Partner Wolt) zugeschnitten ist – ohne dass diese Plattformen eigenes Kapital bereitstellen oder Risiken tragen müssen. Ihr USP ist die radikale Simplifizierung der B2B-Kreditvergabe durch smarte Echtzeit-Datenverknüpfungen. Angetrieben von einer wuchtigen 23-Millionen-Euro-Series-A-Runde, angeführt vom britischen Fonds Blossom Capital und dem Seed-Lead Earlybird, treibt das Start-up seine aggressive europäische Expansion unaufhaltsam voran.

Topi (Exit)

Charlotte Pallua und Estelle Merle brachten Topi 2021 an den Start, um das Hardware-as-a-Service-Modell in den B2B-Bereich zu integrieren. Über die Plattform können B2B-Kund*innen IT-Equipment flexibel mieten, wobei Topi den gesamten Prozess vom Checkout über das Refinancing bis zum Asset-Management abwickelt. Nachdem Topi mit Händler*innen wie Cyberport massiv skalierte und von Top-VCs wie Index Ventures und Creandum finanziert wurde, erfolgte im Sommer 2025 der strategische Exit: Das FinTech wurde von dem internationalen Leasing-Giganten PEAC Solutions (einem BlackRock-Portfoliounternehmen) übernommen, um das innovative B2B-Mietmodell global in dessen gewaltige Finanzierungsinfrastruktur einzugliedern.

Hakuna

Im Bereich Embedded Insurance schlägt das 2021 von Sebastian Jost, Rupert Mayer und Orhan Köroglu gegründete Hakuna neue Wege ein. Das Start-up bietet Händler*innen eine Plattform für Garantieverlängerungen und Produktschutzversicherungen, nahtlos integriert in den Online- und Offline-Checkout. Der USP ist ein völlig neu gedachtes, digitales Schadensmanagement, das die Abwicklung für Endkund*innen radikal vereinfacht. Finanziert von Top-VCs wie Earlybird und Visionaries Club, hat Hakuna mittlerweile den Sprung ins absolute Enterprise-Segment geschafft: Im Jahr 2025 integrierten Branchenriesen wie Vorwerk, STIHL und Mister Spex die Embedded-Technologie des Start-ups, um ihre eigenen, maßgeschneiderten Produktschutzprogramme europaweit zu skalieren.

Pile (Exit)

Jessica Holzbach startete Pile 2022 und pivotierte das Modell nach dem Krypto-Winter erfolgreich zu einem hochspezialisierten Treasury-Angebot für Start-ups. Die B2B-SaaS-Technologie bündelte Konten und automatisierte die Diversifikation von Einlagen zur Risikominimierung. Das Modell erregte schnell Aufmerksamkeit und führte bereits im Sommer 2024 zu einem frühen Exit: Die 2019 gegründete Berliner Neobank Vivid Money übernahm das Start-up, um das eigene Business-Banking-Angebot mit Piles Treasury-Technologie aufzurüsten – ein Paradebeispiel für die rasante Konsolidierung im FinTech-Infrastrukturmarkt.

Internationaler Ausblick & Fazit

Blickt man über die Grenzen Europas hinaus, formen sich 2026 drei gewaltige Makro-Trends, die den deutschen Markt unausweichlich verändern werden. Aus Asien schwappt die Architektur für grenzüberschreitende Echtzeit-Settlements basierend auf regulierten Stablecoins und digitalen Zentralbankwährungen heran, was das traditionelle Korrespondenzbankensystem massiv unter Druck setzt. Die USA hingegen dominieren die Entwicklung der KI-gesteuerten autonomen Finanzen, bei der das Corporate Treasury von Algorithmen gesteuert wird, die ohne menschliches Zutun Liquidität verschieben. Aus Indien lernen wir, wie Identity-as-a-Service untrennbar mit dem Zahlungsverkehr verschmilzt und Betrug nahezu ausmerzt.

Für Gründer*innen und Investor*innen im DACH-Raum bedeutet dies: Der Fokus muss radikal auf Profitabilität, wasserdichter Compliance und extrem stabiler Infrastruktur liegen. Wer heute in Embedded Finance gewinnt, baut keine bunten Apps mehr, sondern die hochkomplexen, unsichtbaren Stahlträger der digitalen Weltwirtschaft.

Schluss mit Swipen: Wie vibe deep aus Dating-Frust ein Relationship-Business machen will

Dating-Apps frustrieren, die Einsamkeit wächst. Das Hamburger Start-up vibe deep setzt daher auf „Deep Talk“ statt Swiping. Eine Analyse des neuen Geschäftsmodells, das beweisen will, dass sich mit emotionaler Tiefe ein skalierbares Tech-Unternehmen aufbauen lässt.

Die makroökonomischen und gesellschaftlichen Vorzeichen für eine Neuausrichtung digitaler sozialer Dienste sind eindeutig. Weltweit gilt laut der Weltgesundheitsorganisation (WHO) mittlerweile jede sechste Person als einsam. Allein in Deutschland geben über 42 Prozent der Bevölkerung an, in regelmäßigen Abständen Einsamkeit zu verspüren. Gleichzeitig zeigen klassische, auf raschen Konsum ausgelegte Dating-Apps massive Ermüdungserscheinungen. Die aktiven Nutzer*innenzahlen von Branchengrößen wie Tinder, Bumble und Hinge fielen im vierten Quartal 2024 global um sechs Prozent. Rund 69 Prozent aller heruntergeladenen Dating-Apps werden bereits innerhalb eines Monats wieder gelöscht.

Vor allem die junge Zielgruppe zieht Konsequenzen: Im Jahr 2024 planten 63 Prozent der Generation Z einen bewussten „Social-Media-Detox“ – mehr als jede andere Generation. Der Markt verlangt ganz offensichtlich nach echter Verbindung statt nach oberflächlichem, medialem Dopamin, welches das Fehlen realer Nähe oftmals nur vernebelt.

Genau in diese Lücke der wachsenden Dating-Ermüdung stößt die App vibe deep, mit der das Hamburger Start-up von Lui und Saskia Michalski den Fokus konsequent auf Deep Talk statt Swiping verschiebt.

Vom Content zum Tech-Produkt

Dabei war der Weg zum Tech-Unternehmen für die Gründer*innen, die zunächst als Content-Creator*innen im Bereich nicht-monogamer Lebensweisen erfolgreich wurden, keine klassische Laufbahn. Doch der Schritt in die Tech-Branche war eine logische Konsequenz aus dem wachsenden Frust ihrer Community. „Der Schlüsselmoment war eigentlich ein schleichender“, erinnert sich Saskia. Jahrelang hätten sie fehlende Tiefe und Einsamkeit thematisiert, doch die Probleme der Menschen seien eher gewachsen als geschrumpft. „Content allein bringt Menschen nicht ins Handeln“, konstatiert Saskia. „Er schafft Bewusstsein, aber keine echte Veränderung.“ Daraus sei der Entschluss gereift, ein Werkzeug zu bauen, das konkrete Interaktion ermöglicht.

Lui ergänzt: „Genau daraus ist vibe deep entstanden: als Produkt, nicht als Content-Verlängerung.“ Um das Vorhaben umzusetzen, übernahm er dank seines Hintergrunds in der Tech-Industrie das Product Management. Unterstützt werden die beiden von einem externen CTO, der die Entwicklung mit einem internationalen Team vorantreibt. Doch die Technik sei nur die halbe Miete: „Die eigentliche Innovation liegt nicht nur in der Technologie, sondern im Verständnis von Beziehungen – und genau das bringen wir als Gründer*innen mit“, betont Lui.

Deep Talk statt Dauerkonsum