Aktuelle Events

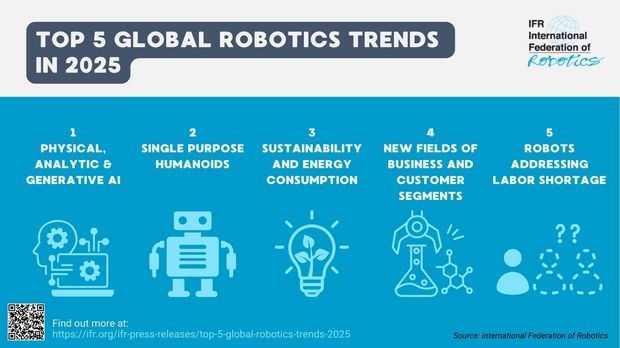

Fünf globale Robotik-Trends 2025

Das sind die wichtigsten Trends, die die Robotik und Automation im Jahr 2025 weltweit prägen werden. Gut zu wissen nicht nur für Robotik-Start-ups und -Gründer*innen.

Der Marktwert installierter Industrie-Roboter hat mit 16,5 Mrd. US-Dollar weltweit einen historischen Höchststand erreicht. Die künftige Nachfrage wird durch technologische Innovationen, neue Marktentwicklungen und die Erschließung neuer Geschäftsfelder angetrieben. Die International Federation of Robotics (IFR) – 1987 als nicht gewinnorientierte Organisation gegründet –, berichtet über die wichtigsten Trends, die die Robotik und Automation im Jahr 2025 prägen werden.

1. Künstliche Intelligenz – Physisch, analytisch, generativ

Der Trend zum verstärkten Einsatz künstlicher Intelligenz (KI) setzt sich fort: In der Robotik helfen verschiedene KI-Technologien dabei, ein breites Spektrum von Aufgaben effizienter auszuführen: Mit analytischer KI lassen sich große Datenmengen verarbeiten und analysieren, die von der Roboter-Sensorik erfasst werden. Dies hilft dabei, auf unvorhersehbare Situationen oder wechselnde Bedingungen in öffentlichen Räumen oder bei der Produktion von „High-Mix-Low-Volume-Aufgaben“ zu reagieren. Mit Bildverarbeitungssystemen ausgerüstete Roboter analysieren ihre Arbeitsschritte, um Muster zu erkennen und Arbeitsabläufe zu optimieren. Ziel ist beispielsweise, Tempo und Präzision zu steigern.

Roboter- und Chip-Hersteller*innen investieren aktuell in die Entwicklung spezieller Hard- und Software, die Umgebungen aus der realen Welt simulieren. Diese sogenannte physische KI ermöglicht es Robotern, sich selbst in solchen virtuellen Umgebungen zu trainieren. Dabei gemachte Erfahrungen treten an die Stelle traditioneller Programmierung. Solche generativen KI-Projekte zielen darauf ab, einen „ChatGPT-Moment“ für physische KI zu schaffen.

KI-gesteuerte Simulationstechnologie für Roboter dürfte sich sowohl in typischen industriellen Umgebungen als auch in Anwendungen der Servicerobotik durchsetzen.

2. Humanoide

Roboter in menschlicher Gestalt erregen große mediale Aufmerksamkeit. Die Vision: Roboter werden zu Allzweckwerkzeugen, die selbständig eine Spülmaschine beladen und gleichermaßen anderswo am Fließband arbeiten können. Robotik-Start-ups arbeiten an diesen humanoiden Alleskönnern.

Industrielle Hersteller*innen konzentrieren sich dagegen auf Humanoide, die zunächst individuelle Einzelaufgaben bewerkstelligen. Die meisten dieser Pilotprojekte laufen in der Automobilindustrie. Diese Branche spielt seit jeher eine Pionierrolle bei der Entwicklung von Roboteranwendungen. Das gilt sowohl für die Industrie-Robotik als auch für die Logistik und Lagerhaltung. Aus heutiger Sicht bleibt jedoch abzuwarten, ob humanoide Roboter einen wirtschaftlich tragfähigen und skalierbaren Business-Case für die breite industrielle Anwendung darstellen werden, insbesondere im Vergleich zu bereits bestehenden Lösungen.

Nichtsdestotrotz gibt es zahlreiche Anwendungen, die von der humanoiden Form profitieren könnten und Marktpotenzial für die Robotik bieten, beispielsweise in der Logistik und Lagerhaltung.

3. Nachhaltigkeit und Energieeffizienz

Die Erfüllung der nachhaltigen Entwicklungsziele der Vereinten Nationen (UN) und damit korrespondierender Regularien weltweit wird zu einer wichtigen Voraussetzung sich als Lieferant*in zu qualifizieren. Roboter spielen für Hersteller*innen eine Schlüsselrolle, wenn es darum geht, diese Ziele zu erreichen.

Grundsätzlich verringert Robotik mit ihrer Präzisionsarbeit die Verschwendung von Material und verbessert das Output zu Input-Verhältnis in Fertigungsprozessen. Diese automatisierten Systeme gewährleisten zudem eine gleichbleibende Qualität, die für Produkte mit langer Lebensdauer und minimalem Wartungsaufwand unerlässlich ist. Bei der Herstellung umweltfreundlicher Energietechnologien wie Solarzellen, Batterien für Elektroautos oder Recyclinganlagen sind Roboter für eine kosteneffiziente Produktion von entscheidender Bedeutung. Sie ermöglichen es Hersteller*innen, ihre Produktion schnell zu skalieren, um eine wachsende Nachfrage der Kund*innen zu befriedigen, ohne Kompromisse bei der Qualität oder Nachhaltigkeit einzugehen.

Darüber hinaus wird die Robotertechnologie dahingehend verbessert, Maschinen energieeffizienter zu machen: Die Leichtbauweise beweglicher Roboterkomponenten senkt beispielsweise deren Energieverbrauch, ebenso neue Standby-Modi, die die Hardware in eine energiesparende Parkposition bringen. In der Greifer-Technologie gibt es Fortschritte bei der Anwendung bionischer Lösungen, um z.B. eine starke Greifkraft bei sehr geringem Energieverbrauch zu erreichen.

4. Neue Geschäftsfelder und Kund*innenbranchen für die Robotik

In der Fertigungsindustrie gibt es insgesamt noch viel Potenzial für die Automation mit Robotern. Die meisten Betriebe im produzierenden Gewerbe zählen zu den kleineren und mittelgroßen Unternehmen (KMU). Aktuell stellen hohe Anfangsinvestitionen und Gesamtbetriebskosten für KMU jedoch eine Hürde für den Einsatz von Industrie-Robotern dar. Geschäftsmodelle wie Robot-as-a-Service (RaaS) sollen es Unternehmen erleichtern, von der Roboterautomatisierung zu profitieren, ohne eine festgelegte Kapitalsumme investieren zu müssen. RaaS-Anbietende, die sich auf bestimmte Branchen oder Anwendungen spezialisiert haben, können schnell anspruchsvolle Lösungen liefern. Darüber hinaus bietet die Low-Cost-Robotik Lösungen für potenzielle Kund*innen, für die ein Hochleistungsroboter überdimensioniert wäre. Viele Anwendungen haben geringe Anforderungen an Präzision, Traglast und Lebensdauer. Die Low-Cost-Robotik adressiert dieses neue „good enough“-Segment.

Abseits des produzierenden Gewerbes gehören Bauwirtschaft, Laborautomation und Lagerhaltung zu interessanten neuen Kund*innensegmenten. Branchenübergreifend wird die Nachfrage darüber hinaus von einem Ausbau inländischer Produktionskapazitäten in strategisch wichtigen Branchen angetrieben, deren Bedeutung aufgrund der jüngsten Krisen ins politische Bewusstsein gerückt ist. Die Automatisierung ermöglicht Hersteller*innen eine Rückverlagerung von Produktionskapazitäten näher zum/zur Kund*in ohne Einbußen bei der Kosteneffizienz.

5. Roboter gegen den Arbeitskräftemangel

Nach Angaben der Internationalen Arbeitsorganisation (ILO) leidet das verarbeitende Gewerbe weltweit weiterhin unter Arbeitskräftemangel. Einer der Hauptgründe dafür ist der demografische Wandel, der die Arbeitsmärkte in führenden Volkswirtschaften wie den Vereinigten Staaten, Japan, China, der Republik Korea und Deutschland belastet. Die konkreten Effekte sind zwar von Land zu Land unterschiedlich, aber in der Summe überall in der Lieferkette ein Grund zur Besorgnis.

Der Einsatz von Robotern verringert die Auswirkungen des Arbeitskräftemangels in der Fertigung deutlich. Mit der Automation von gefährlichen, schmutzigen oder repetitiven Tätigkeiten, können sich menschliche Arbeitskräfte auf interessantere und höherwertige Aufgaben konzentrieren. Roboter übernehmen Arbeiten wie ermüdende visuelle Qualitätskontrollen, gesundheitsschädliche Lackierarbeiten oder schweres Heben von Lasten. Technologische Innovationen wie einfache Bedienbarkeit, kollaborierende Roboter oder sogenannte mobile Manipulatoren helfen Lücken im Arbeitsprozess zu füllen, wann und wo immer sie benötigt werden.

Diese Artikel könnten Sie auch interessieren:

Fahrfuchs: Kein Führerschein, aber das Auto neu gedacht

Die Gründer Florian Ritzel und Jannik Kirchhoff aus Hamburg wollen das Problem der versteckten Autokosten lösen. Ihre App Fahrfuchs kletterte ohne Marketingbudget in die Top 100 der Finanz-Charts im App Store – eine klassische Bootstrapping-Erfolgsgeschichte. Doch wie tragfähig ist das Geschäftsmodell, wenn etablierte Konkurrenten den Markt beherrschen?

Während andere Abiturient*innen für Klausuren büffeln, programmierten Florian Ritzel und sein Mitgründer Jannik Kirchhoff (beide 18) ein Start-up. Die Initialzündung war laut den beiden Hamburger Gymnasiasten eine gesellschaftliche Beobachtung: Die Belastung durch Mobilitätskosten. „Die alleinerziehende Mutter sollte nicht an der Zapfsäule stehen müssen und entscheiden, ob sie ihr Kind in die Kita oder sich selbst zur Arbeit fährt“, beschreibt Ritzel die Motivation hinter dem Projekt. Die amüsante Ironie ihrer Gründung: Die Fahrfuchs-Gründer besitzen aktuell nicht einmal einen Führerschein.

Auf die naheliegende Skepsis bezüglich dieses fehlenden „Nutzer-Wissens“ reagiert Florian Ritzel offensiv: „Natürlich gibt es immer Leute, die unsere Idee kritisieren. Und fehlendes Nutzerwissen ist gerade am Anfang schwierig, vor allem, wenn man eine App bauen möchte, die möglichst vielen Menschen hilft.“ Doch aus der vermeintlichen Schwäche machten sie eine Stärke durch maximale Nutzerorientierung. „Wir haben bereits vorher im Umfeld rumgefragt, was die Leute eigentlich brauchen, und danach gezielt um Feedback gebeten“, erklärt der Gründer. Der Erfolg gibt ihnen recht: „Inzwischen erreichen uns täglich dutzende Mails mit Tipps – was die Nutzer*innen sich wünschen und wie wir die App verbessern können. Dadurch wird uns das Ganze nicht zum Verhängnis, sondern sogar zum Vorteil.“

Mit Fahrfuchs wollen sie den rund 48,5 Millionen Pkw-Halter*innen in Deutschland auf den Cent genau aufzeigen, wo das Auto wirklich Geld frisst. Denn der teure Kraftstoff ist nur ein Teil der Wahrheit. Falsche Versicherungstarife, unbemerkter Wertverlust, Wartung und vergessene Pendlerpauschalen reißen oft weitaus größere Löcher ins Budget. Die Resonanz ist für die frühe Phase beachtlich: Ganz ohne bezahltes Marketing sammelte die App schnell über 700 Downloads ein – eine für den Massenmarkt zwar noch bescheidene Zahl, die jedoch ausreichte, um mehrfach in die Top 100 der Finanz-Charts im App Store zu stürmen. Zudem generierte das Projekt rein organisch Presseberichte, unter anderem in der FAZ, der SWP und bei Antenne Bayern.

Holistischer Ansatz statt reiner Tank-App

Auf den ersten Blick wirkt Fahrfuchs wie ein weiterer Spritpreis-Radar. Die App zieht in Echtzeit Daten der Markttransparenzstelle für Kraftstoffe, listet Ladesäulen für E-Autos und alarmiert per Push-Nachricht bei günstigen Preisen. Der entscheidende Pivot ist jedoch das ganzheitliche Kostentracking: Die Gründer haben einen eigenen Versicherungsrechner sowie einen Steuer-Sparrechner integriert, bieten detaillierte Monatsreports an und binden die Nutzer*innen über einen Gamification-Ansatz („Sparfuchs-Score“). Ein zentrales Versprechen in Zeiten von Datenskandalen: Alle sensiblen Nutzer*innendaten werden lokal auf dem Endgerät gespeichert – es gibt keine zentrale Cloud.

Angesprochen auf die Skalierbarkeit dieses Modells bezieht Jannik Kirchhoff klar Stellung: „Die lokale Datenspeicherung ist gerade in Deutschland kein strategisches Eigentor. Ich halte nichts für wichtiger, als die privaten Daten unserer Nutzer*innen zu schützen“. Er warnt vor den Risiken zentraler Speicherlösungen: „Niemand muss wissen, wo ich wohne, wohin ich morgens fahre oder wo meine Kinder zur Kita gehen. Wir haben in der Vergangenheit immer wieder gesehen, dass jeder gehackt werden kann. Und gerade als junge Entwickler können und wollen wir diese Verantwortung nicht übernehmen“. Personalisierte Spar-Vorschläge ließen sich laut Kirchhoff auch direkt auf dem Smartphone „hervorragend realisieren“.

Ein echtes Haifischbecken

Die Vision ist ambitioniert, doch der Markt ist hart umkämpft. Die Konkurrenz reicht von Excel-Tabellen bis zu Platzhirschen wie Spritmonitor oder Giganten wie Clever Tanken. Warum also wechseln? Florian Ritzel gibt sich selbstbewusst: „Die Spritpreis-Übersicht ist bei uns nur eines von vielen Features – nicht der Hauptteil. Wer Spritmonitor so gut findet, darf dort gerne bleiben.“ Der Fokus liege woanders: „Wer aber wirklich tracken möchte, was sein Auto insgesamt kostet, der kann das eben nur bei uns. Diese Gesamtheit an Features gibt es bisher in keiner anderen App in dieser Form.“ Selbst das Argument der manuellen Excel-Tabelle lässt er nicht gelten: „Natürlich kann man sich das selbst in Excel bauen – aber darauf haben die meisten Leute schlicht keine Lust. Genau deswegen sind wir so gut.“

Kritisch hinterfragt

Trotz des Aufklärungscharakters ist Fahrfuchs kein reines Hobbyprojekt; In-App-Käufe für eine „Plus“-Version (0,99 €/Monat) sowie eine „Pro“-Version (2,99 €/Monat bzw. 19,99 €/Jahr) bilden das Monetarisierungsmodell. Ob die selbstgestrickte Mathematik hinter dem Versicherungsrechner, der auf hunderten per Hand durchgerechneten Profilen basiert, ohne echte API-Schnittstellen dauerhaft standhält, bleibt abzuwarten.

Wie viele Abonnent*innen braucht es, um nach dem Abitur davon zu leben? Jannik Kirchhoff rechnet vor: „Ehrlicherweise vermutlich mehr als 10.000 zahlende Abonnent*innen – aber das ist zunächst auch nicht unser Ziel.“ Aktuell stehe das Lernen im Vordergrund: „Wir wollen vor allem Erfahrungen sammeln durch das, was wir machen, und gleichzeitig die laufenden Kosten decken. Das sollte demnächst möglich sein.“

Für die Zeit nach dem Abschluss hält er sich alle Türen offen: „Risikokapital halte ich ab dem Moment für unumgänglich, an dem wir wirklich konkret expandieren wollen. Das wird vermutlich nach dem Abitur der Fall sein. Dann muss man schauen, ob es sich lohnt, Anteile abzugeben oder Kredite aufzunehmen.“ Sein Fazit: „Spannend wird es erst, wenn wir die Idee wirklich groß skalieren wollen.“

Ein exzellentes MVP mit Pivot-Potenzial

Fahrfuchs ist ein Lehrbuchbeispiel für ein hervorragendes Minimum Viable Product (MVP). Um jedoch hochprofitabel zu werden, könnte mittelfristig ein Wechsel hin zur Affiliate-Provision für Versicherungswechsel nötig sein. Doch hier bremst Florian Ritzel bewusst: „Versicherungspartner wollen wir zunächst bewusst nicht werden, denn einer der entscheidendsten Punkte unserer App ist, dass wir Versicherungsdaten unabhängig zur Verfügung stellen.“

Sein Ziel ist technologische Exzellenz: „Meilenstein eins ist, den Versicherungsrechner so akkurat zu machen, dass wir auf Check24-Niveau sind – ohne dafür Provisionen zu kassieren.“ Zudem plane man Kooperationen mit Fahrschulen und Werkstätten, um die Leute genau dort zu erreichen, „wo sie am meisten ans Auto denken“. Die größte Hürde bleibt derweil technischer Natur: „Meilenstein drei ist die Android-Version – das ist allerdings extrem schwer umzusetzen, gerade wenn man iOS-Coding gewohnt ist.“ Dennoch verspricht er: „Wir planen das aber innerhalb der nächsten drei Monate.“

Der Grundstein ist gelegt. Nun müssen die beiden Hamburger beweisen, dass sie nach dem Abitur nicht nur programmieren, sondern auch unternehmerisch durch den dichten Verkehr des Mobilitätsmarktes navigieren können.

KI gegen Beamtendeutsch: Wie ein Solo-Gründer den Markt für Nebenkosten aufrollt.

Für die meisten der rund 19 Millionen Mieterhaushalte in Deutschland ist sie ein jährliches Ärgernis: die Nebenkostenabrechnung. Laut dem Deutschen Mieterbund enthält jede zweite Abrechnung Fehler. Das fränkische Start-up NebenkostenPro will diesen intransparenten Markt nun mithilfe Künstlicher Intelligenz radikal vereinfachen – und zwar für beide Seiten.

Bisherige Lösungsansätze für fehlerhafte Abrechnungen – von unzulässigen Verwaltungskosten bis zu falsch umgelegten Reparaturen – waren für Mieterinnen und Mieter oft teuer oder zeitaufwendig. Der Gang zur Anwaltskanzlei frisst die Ersparnis schnell auf, Mietervereine binden einen an jährliche Mitgliedschaften und etablierte LegalTech-Wettbewerber verlangen für eine manuelle Prüfung meist rund 50 Euro.

Hinter dem Lösungsansatz von NebenkostenPro steht kein großes Entwicklerteam, sondern Julian Falk, ein Solo-Gründer aus Zirndorf bei Nürnberg. Auf die Frage, wie man sich freiwillig in die juristischen Untiefen der Betriebskostenverordnung stürzt, hat Falk eine verblüffend einfache Antwort: „Ehrlich gesagt war der Auslöser ziemlich banal“, erinnert sich der Gründer. „Ich habe selbst als Mieter eine Nebenkostenabrechnung bekommen, bei der die Zahlen einfach nicht plausibel wirkten“.

Als er sich einlesen wollte, landete er prompt im deutschen Paragraphendschungel. „Da habe ich gemerkt: Wenn ich als technikaffiner Mensch schon Probleme habe, das zu durchdringen, wie soll das ein normaler Mieter schaffen?“ Falk erkannte schnell, dass die Betriebskostenverordnung im Kern aus klaren Wenn-Dann-Strukturen besteht. „Das schreit förmlich nach Automatisierung“, fasst er seinen Heureka-Moment zusammen.

KI als Herausforderer im zweiseitigen Markt

Was als Wochenendprojekt begann, wuchs schnell. Heute nutzt die Plattform eine komplexe Pipeline aus mehreren KI-Modellen, um hochgeladene PDF-Dokumente und Fotos auszulesen, zu strukturieren und juristisch einzuordnen. Der Clou dabei ist der duale Ansatz, der beide Marktseiten bedient. Für Mieter*innen dient das Tool zunächst der Symptombekämpfung, indem ein initialer Schnellcheck die hochgeladenen Daten kostenlos mit lokalen Vergleichswerten abgleicht. Der detaillierte Prüfbericht startet bei einer preislichen Kampfansage von 7,90 Euro. Für Vermieter*innen fungiert die Plattform hingegen als Software-as-a-Service zur rechtskonformen Erstellung der Abrechnungen.

Dieses B2B-Abo-Modell ist für das Überleben der Firma essenziell. Es sorgt für den dringend benötigten wiederkehrenden Umsatz, der das stark saisonale, von geringer Kund*innenbindung geprägte Mieter*ingeschäft wirtschaftlich ausbalanciert.

Wer nun glaubt, hinter einer solch komplexen KI-Pipeline stünden „Heerscharen“ von Investoren, irrt. „NebenkostenPro ist komplett eigenfinanziert. Es gibt keine externen Geldgeber, keine Investoren, keine Beteiligungen“, betont Falk. Das Modell trage sich mittlerweile selbst – für Falk ein Blick in die Zukunft der Softwareentwicklung. „KI verändert gerade fundamental, wie Software-Unternehmen entstehen. Die Werkzeuge, die heute verfügbar sind, machen einen einzelnen Gründer so produktiv wie früher ein ganzes Team.“ Die Rolle des/der Entwickler*in verschiebe sich zunehmend zum/zur Architekt*in, der lediglich die Richtung vorgebe und Ergebnisse validiere.

Smarte Daten als Reichweiten-Hebel

Um gegen etablierte LegalTech-Player wie Wenigermiete oder Mieterengel anzukommen, fehlte dem Solo-Gründer schlicht das Marketingbudget. Falks clevere Antwort: Er baute eine frei zugängliche Wissensdatenbank mit kommunalen Nebenkostendaten für rund 400 deutsche Städte auf – von Grundsteuer-Hebesätzen bis zu lokalen Wasserpreisen.

Ein massiver Hebel, der sich auszahlt: Die Datenbank wird mittlerweile sogar von Google und KI-Modellen wie ChatGPT als primäre Quelle zitiert, was organischen Traffic generiert, ohne teure Klickpreise für umkämpfte Keywords zahlen zu müssen.

Konvertiert dieser Traffic auch? „Die Seite rankt für zahlreiche organische Keywords, der Traffic vervielfacht sich von Monat zu Monat“, freut sich der Gründer. Das beste Marketing sei ohnehin die Mundpropaganda erfolgreicher Nutzer*innen. Eine Entwicklung verblüfft den Zirndorfer dabei besonders: „Was mich überrascht hat: Die Vermieterseite wächst schneller als die Mieterseite.“ „Viele private Kleinvermieter kämpfen sich jedes Jahr mit Excel durch ihre Abrechnung und sind dankbar, wenn ihnen das jemand abnimmt.“

Juristisches Minenfeld und das Haftungsrisiko

Doch wo KI auf deutsches Mietrecht trifft, lauern Gefahren. Bedingt durch das Rechtsdienstleistungsgesetz darf NebenkostenPro keine formelle Rechtsberatung anbieten, sondern liefert lediglich Indizien und Muster-Widersprüche ohne bindende Vertretung. Zudem stoßen reine Sprachmodelle bei komplexen Sonderfällen – etwa einer gewerblich-privaten Mischnutzung – an ihre Grenzen.

Auf die berüchtigten „Halluzinationen“ von Sprachmodellen angesprochen, reagiert Falk pragmatisch. Er setze nicht auf ein einziges Modell, sondern auf eine spezialisierte Pipeline mit klar abgegrenzten Aufgaben. Die eigentliche Analyse basiere dann nicht auf Freitext-Antworten der KI, sondern auf einem präzisen Abgleich extrahierter Werte mit konkreten Gesetzestexten.

Zudem übt der Gründer Kritik an der generellen KI-Skepsis. „Was mich bei der Debatte um KI-Halluzinationen immer etwas stört: Wir tun so, als wäre das ein reines KI-Problem. In Wahrheit halluzinieren Menschen ständig“, kontert er. „Ein Sachbearbeiter, der zum dritten Mal an diesem Tag eine Abrechnung prüft, übersieht Fehler. Ein Vermieter, der seine Abrechnung in Excel zusammenbastelt, vertippt sich. KI lügt nicht strategisch, sie berechnet Wahrscheinlichkeiten.“

Um sich vor Regressansprüchen zu schützen, schiebt die Plattform die finale Verantwortung konsequent auf die Nutzer*innen ab. „Man muss mit KI genauso umgehen wie mit einem Kollegen. Den Output hinterfragen, nicht blind vertrauen“, mahnt Falk. Wer als Vermieter*in das Tool nutze, sei am Ende selbst für die Richtigkeit der eingegebenen Daten und das finale Dokument verantwortlich. „Bei komplexen Sonderfällen empfehlen wir ausdrücklich den Gang zur Fachberatung“, räumt er ein. Auch dem strengen Datenschutz bei Finanzdokumenten begegnet er kompromisslos: Daten kostenloser Nutzer*innen werden nach der Erstellung sofort gelöscht und alle Übertragungen werden strikt verschlüsselt.

David gegen die LegalTech-Goliaths

NebenkostenPro steht für den aktuellen Trend rund um gebootstrappte KI-Start-ups, bei denen ein(e) einzelne(r) Gründer *inmoderne Sprachmodelle nutzt, um teure menschliche Arbeitskraft zu kommoditisieren. Doch was hindert Branchenriesen mit riesigen Budgets daran, Falks Idee mittels offener KI-Schnittstellen einfach zu kopieren?

Falk gibt sich entspannt und räumt ein, dass die reine KI-Technologie kein echter Burggraben sei. Sein Vorteil liege im Domänenwissen und in der Agilität: „Als die CO2-Kostenaufteilung kam, hatte ich das schneller drin als die meisten etablierten Anbieter.“ Zudem bediene NebenkostenPro als einzige Plattform beide Marktseiten – sie prüft für die einen und erstellt für die anderen.

Am Ende, so ist sich der Gründer sicher, gewinne nicht derjenige mit dem größten Team, sondern der Schnellere. „Der Vorsprung entsteht nicht durch eine einmalige technische Idee, sondern dadurch, dass man jeden Tag nah am Nutzer baut und schneller iteriert als die Konkurrenz.“

Zwischen Bildungsdschungel und digitaler Übersicht: Kann das Münchner Start-up kursmap den Weiterbildungsmarkt knacken?

Der Markt für berufliche Weiterbildung in Deutschland ist riesig, extrem fragmentiert – und für Suchende oft frustrierend unübersichtlich. Dariusz Opitek will das Problem mit seinem Start-up kursmap – einer zentralisierten Plattform – lösen. Ein klassisches Plattform-Modell, das schnelles Wachstum verspricht, aber auch bekannte Fallstricke birgt.

Wer in Deutschland nach einer spezifischen beruflichen Fortbildung sucht, landet schnell in einem Labyrinth aus schlecht gepflegten Websites, PDF-Broschüren und intransparenten Preisstrukturen. Genau in diese Lücke stößt die 2025 in München gegründete kursmap GmbH. Erst kürzlich meldete das Start-up einen Meilenstein: Über 150.000 Kurstermine von Präsenz-, Inhouse- und Online-Schulungen sind laut Unternehmensangaben mittlerweile auf der Plattform gebündelt. Doch ist das Modell tragfähig genug, um sich gegen die etablierten Branchengrößen durchzusetzen?

Hinter kursmap steht Gründer und Geschäftsführer Dariusz Opitek. Seine Motivation entsprang einem klassischen Pain Point: Viele Interessierte wissen schlichtweg nicht, welche qualifizierten Anbieter sich in unmittelbarer Nähe befinden. Mit der Vision, „Weiterbildungen sichtbar, digital und einfach zugänglich zu machen“, brachte Opitek die Plattform an den Start.

Doch eine bloße Aggregation von Daten reicht im heutigen Tech-Umfeld selten aus. Bisher steht der Gründer stark im Vordergrund. Auf die Frage, wer neben ihm im Kernteam stehe, um dieses Mammutprojekt zu stemmen, überrascht Opitek mit einer klaren Ansage: „Kursmap ist aktuell noch eine One-Man-Show, und das bewusst.“ Er agiere als Entwickler, SEO-Stratege und Vertriebler in Personalunion. „Was manche als Schwäche sehen, ist für mich ein Vorteil: kurze Entscheidungswege, keine Overhead-Kosten, maximale Fokussierung“, argumentiert der Gründer.

Um sich gegen gut finanzierte Copycats abzusichern, braucht es allerdings einen technologischen Burggraben. Diesen sieht Opitek im Einsatz künstlicher Intelligenz. Er betont, man baue aktuell ein intelligentes Matching-System, das weit über eine klassische Suchmaske hinausgehe. „Nutzer sollen auf Basis ihrer individuellen Situation, ihrer beruflichen Ziele, dem Standort und den aktuellen Marktentwicklungen die passenden Weiterbildungen vorgeschlagen bekommen“, verspricht er. Nicht die erstbeste Option zähle, sondern die richtige. Opitek fasst den Kern seiner Technologie selbstbewusst zusammen: „Das ist keine Datenbank-Logik, das ist ein persönlicher Weiterbildungsberater, der rund um die Uhr verfügbar ist.“

Die Resterampe-Gefahr: Masse statt Klasse?

Die Marke von 150.000 Terminen ist zweifellos beeindruckend. Erreicht wurde dies, indem kursmap die Einstiegshürden für Anbieter bewusst bei null hält, sodass diese eigenständig Profile anlegen können. Genau hier liegt jedoch das größte Risiko: Marktplätze, die auf pure Quantität setzen, laufen schnell Gefahr, mit veralteten Daten oder unseriösen Angeboten der Coaching-Szene überflutet zu werden.

Wie verhindert das Start-up also, zur unregulierten Resterampe zu verkommen? Opitek wehrt sich vehement gegen den Verdacht mangelnder Kontrolle. „Ein niedriger Einstieg bedeutet nicht, dass wir die Augen verschließen, im Gegenteil“, kontert er. Laut dem Geschäftsführer werden alle Profile laufend überprüft, und es gebe klare Prozesse zum Eingreifen. Dass man auf aufwendige Onboarding-Gespräche oder intransparente Anforderungen verzichtet, sei eine sehr bewusste Entscheidung gewesen. Opitek rechtfertigt diesen Weg: „Das schadet besonders kleinen, oft hervorragenden Anbietern, die schlicht nicht die Kapazitäten für bürokratische Hürden haben.“ Sein Credo für die Plattform lautet daher: „Wer gute Kurse anbietet, soll sofort loslegen können. Qualität muss man sich nicht erzwingen, man muss sie fördern.“

Wer zahlt am Ende die Rechnung?

Das Geschäftsmodell basiert auf der kostenlosen Listung für Anbieter*innen, um zügig ein attraktives Angebot aufzubauen. Das Kalkül: Sobald darüber Leads generiert werden, lassen sich diese künftig über Premium-Modelle monetarisieren. Doch um überhaupt Lernende auf die Plattform zu locken, muss kursmap in Google Ads und im organischen Ranking hart gegen etablierte Portale kämpfen – ein Spiel, das meist massiv Kapital verbrennt.

Finanziert das Start-up diesen teuren Sichtbarkeitskampf aus eigener Kraft, oder braucht es dringend externes Venture Capital (VC)? Opitek setzt auf organisches Wachstum durch SEO. „Hochwertige, relevante Inhalte sind die nachhaltigste Investition, die eine Plattform wie kursmap machen kann“, erklärt er. Sichtbarkeit, die man sich hart erarbeite, sei langlebiger als erkaufte Reichweite. Er räumt zwar ein, ergänzend Google Ads zu nutzen, betont jedoch, dass dies hochgradig selektiv passiere. „Kursmap ist und bleibt bootstrapped“, stellt der Gründer klar. Das zwinge das Unternehmen zur Disziplin. Risikokapital sieht er derzeit eher pragmatisch: „Venture Capital ist für uns kein Ziel, sondern eine Option, die wir nur dann in Betracht ziehen würden, wenn sie uns schneller zu unserem Ziel bringt, nicht als Ersatz für ein funktionierendes Modell.“

Der B2B-Pivot: Raus aus dem Google-Hamsterrad

Kursmap agiert in einem Haifischbecken und tritt gegen Portale wie KURSNET, Semigator oder Tech-Riesen wie LinkedIn Learning an. Deutlich spannender als das margenschwache Vermittlungsgeschäft ist daher die langfristige Vision: Opitek plant B2B-Lösungen, mit denen Unternehmen ihre Weiterbildungsbudgets direkt über kursmap verwalten können. Gelingt dieser Wechsel zum B2B-SaaS-Modell, würde sich das Start-up aus der völligen Abhängigkeit vom Google-Traffic befreien.

Doch warum sollten Personalleiter*innen einem Neuling vertrauen statt auf bewährte Features ihrer HR-Software wie Personio oder Workday zu setzen? Auf die konkrete Frage nach der B2B-Strategie bleibt Opitek bei der technischen Ausführung vage und gibt offen zu: „Wie genau wir ihn gestalten, ob als eigenständiges HR-Tool oder als integriertes Feature für Unternehmen, wird die Marktentwicklung zeigen. Wir sind da ehrlich: Wir testen, lernen und passen uns an.“ Gleichzeitig grenzt er sich aber scharf von großen Suiten ab, die oft die inhaltliche Qualität von Weiterbildungsentscheidungen vernachlässigen würden. „Ein Unternehmen, das diesen Mehrwert für seine Mitarbeitenden spürt, wird kursmap nicht als Konkurrenz zu Personio oder Workday sehen, sondern als sinnvolle Ergänzung“, ist Opitek überzeugt.

Booking.com der Bildung oder teure Illusion?

Kursmap greift ein reales Problem in einem oft digital rückständigen Markt auf. Ob das Start-up langfristig aber das „Booking.com für Fortbildungen“ wird, hängt von rigoroser Qualitätssicherung, effizienter Traffic-Skalierung und der Umsetzung der B2B-Pläne ab.

Bleibt am Ende die Frage nach der Langzeitstrategie: Exit oder Industriestandard? Der Gründer strebt die Spitze im deutschsprachigen Raum an, indem man als „aktiver Partner“ fungiere. Gerade weil KI derzeit ganze Berufsbilder umkrempele, bräuchten Menschen laut Opitek keine bloßen Trefferlisten mehr.

„Kursmap soll genau diese Orientierung geben, datenbasiert, individuell, zukunftsgerichtet“, formuliert Opitek seine Ambition. Sollte dies in Deutschland greifen, schließt er eine Expansion nach Europa nicht aus. Einem unkontrollierten Hype erteilt er zum Schluss jedoch eine deutliche Absage: „Wir denken nicht in Szenarien, sondern in Meilensteinen. Erst liefern, dann skalieren.“

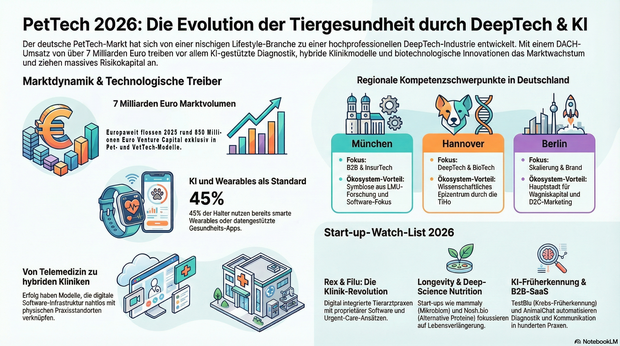

PetTech-Start-up-Report 2026

Wie DeepTech und KI den aktuellen PetTech-Markt prägen und welche Start-ups das Segment hierzulande dominieren. Plus: Die exklusive Start-up-Watch-List.

In den vernetzten De-Novo-Kliniken Berlins und Münchens scannen KI-Algorithmen heute in Millisekunden die MRT-Bilder von Haustieren, während personalisierte Longevity-Supplemente vollautomatisch an das Smart-Home der Halter geliefert werden. Der Vierbeiner des Jahres 2026 ist ein Premium-Patient und voll integrierter digitaler Lifestyle-Avatar, der eine hochkomplexe Gesundheitsökonomie antreibt. Venture-Capital-Fonds analysieren mittlerweile die Auslastungsquoten tierärztlicher Computertomographen genauso akribisch wie die wiederkehrenden Software-Umsätze im B2B-Sektor.

Wir blicken auf eine knallhart professionalisierte Industrie, in der radikale Effizienz und DeepTech den Takt angeben. Es geht um Algorithmen-gestützte Frühdiagnostik, hochskalierbare Praxis-Infrastrukturen und biotechnologische Nahrung – eine Ära, in der pure Tierliebe direkt auf tiefgreifende wissenschaftliche Innovation trifft und Investitionen in Milliardenhöhe rechtfertigt.

Ein hochreifer Milliardenmarkt unter KI-Einfluss

Der deutsche Markt für Heimtiere hat einen beispiellosen Reifegrad erreicht. Mit weit über 34 Millionen Haustieren allein in der Bundesrepublik sprechen wir von einem adressierbaren Markt, der längst nicht mehr nur Premium-Futter, sondern zunehmend hochpreisige Gesundheits- und Tech-Dienstleistungen konsumiert. Der technologische Haupttreiber im Jahr 2026 ist zweifelsohne die künstliche Intelligenz, dicht gefolgt von tiefen Integrationen des Internets der Dinge im Alltag der Tiere.

Laut einer aktuellen Bitkom-Studie nutzen mittlerweile über 45 Prozent der Halter*innen in Deutschland smarte Wearables oder datengestützte Gesundheits-Apps für ihre Tiere. Das spiegelt sich auch in den Bilanzen wider: Der Branchenumsatz im DACH-Raum hat die 7-Milliarden-Euro-Marke signifikant überschritten. Dabei flossen laut jüngsten Auswertungen von KfW Research im vergangenen Jahr europaweit rund 850 Millionen Euro Venture Capital exklusiv in Pet- und VetTech-Modelle.

Die neuen Treiber: Kliniken, Longevity und SaaS-Infrastruktur

Aktuell dominieren im PetTech-Sektor drei hochspezifische Sub-Sektoren den Markt. Allen voran steht der Bereich der De-Novo Vet-Tech-Kliniken. Hier verschmelzen physische Tierarztpraxen mit einer proprietären, durchdigitalisierten Software-Infrastruktur, die von der Terminbuchung bis zur KI-gestützten Diagnostik reicht. Etablierte Pioniere wie das Berliner Start-up Rex haben den Weg für diese hybriden Modelle geebnet.

Ein weiterer massiver Treiber ist die Pet-Longevity in Kombination mit DeepTech-Nutrition. Hier geht es nicht mehr um getreidefreies Futter, sondern um mikrobiom-basierte Nahrungsergänzungen und Alternative Proteine aus dem Bioreaktor, die das Leben der Tiere nachweislich verlängern sollen.

Der dritte dominierende Sektor ist B2B-Vet-SaaS. Start-ups bauen spezialisierte Software für Tierärzte, die Bilderkennung für Scans automatisiert und dem chronischen Fachkräftemangel in den Praxen entgegenwirkt.

Die geplatzten Träume der Solo-Telemedizin

Doch der Weg in dieses reife Marktumfeld war gepflastert mit schmerzhaften Lektionen. Der prominenteste Crash der jüngeren Vergangenheit war die spektakuläre Insolvenzwelle im Bereich der reinen Pet-InsurTechs und Solo-Telemedizin-Plattformen um das Jahr 2023 und 2024. Ein Paradebeispiel war das Berliner Neo-Versicherungs-Start-up Coya, das sich stark auf Tierversicherungen fokussiert hatte, vom französischen Konkurrenten Luko geschluckt wurde und letztlich in einem Insolvenzverfahren endete. Gleichzeitig verbrannten reine Tele-Vet-Apps, die ohne eigene physische Kliniken operierten, Millionen an VC-Geldern.

Aus diesen Debakeln lassen sich vier konkrete, fatale Fallstricke für heutige Gründer ableiten. Erstens die tödliche B2C-Kund*innenakquisitions-Falle: Wer heute im Pet-Bereich rein auf Performance-Marketing in sozialen Netzwerken setzt, wird von den astronomischen Customer Acquisition Costs erdrückt. Zweitens die Ignoranz gegenüber der Regulatorik, insbesondere der Gebührenordnung für Tierärzte. Der Gebührenschock der vergangenen Jahre brach Geschäftsmodellen das Genick, die diese Preissteigerungen nicht einkalkuliert hatten. Drittens das Dogma, dass Technologie den persönlichen Kontakt ersetzen kann: Haustiere können nicht ausschließlich über einen Bildschirm behandelt werden; wer keine physischen Anlaufstellen hat, scheitert an der Realität der Tiermedizin. Viertens die Vernachlässigung der Unit Economics zugunsten eines ungesunden Wachstums, was in einem Markt mit starker lokaler Bindung unweigerlich zum Cashflow-Kollaps führt.

Das deutsche PetTech-Netzwerk

Die deutsche PetTech-Landschaft hat sich auf wenige, aber extrem leistungsstarke Hubs konzentriert. München führt diese Liste unangefochten an. Mit der Ludwig-Maximilians-Universität, die eine der weltweit angesehensten tierärztlichen Fakultäten beheimatet, und dem InsurTech Hub Munich entsteht hier die perfekte Symbiose aus medizinischer Forschung und starkem B2B-Software-Fokus. Hannover verteidigt seinen Status als wissenschaftliches Epizentrum durch die Stiftung Tierärztliche Hochschule Hannover. Aus dem Umfeld dieser Elite-Forschungseinrichtung entspringen derzeit die tiefgreifendsten DeepTech- und BioTech-Ausgründungen der Branche. Berlin hingegen bleibt die unangefochtene Hauptstadt für Skalierung, Wagniskapital und D2C-Brandbuilding. Hier sitzen die großen Geldgeber*innen und Marketing-Genies, gestützt durch lokale Netzwerke. Leipzig komplettiert das Quartett als aufstrebender Star: Die Kombination aus der Veterinärmedizinischen Fakultät der Universität Leipzig und der BioCity, einem exzellenten Cluster für Biotechnologie, zieht zunehmend Start-ups an, die an der Schnittstelle von Tiergesundheit und Zellbiologie arbeiten.

Investor*innen-Radar

Das Kapital fließt heute intelligenter und zielgerichteter. Bei den spezialisierten VCs dominieren Fonds wie Five Seasons Ventures, die tiefes Verständnis für die Schnittstelle von FoodTech und Pet-Nutrition mitbringen, sowie global agierende Vehikel wie der Companion Fund. Im Bereich der Top-Tier Generalisten haben europäische Schwergewichte wie Cherry Ventures, Vorwerk Ventures und DN Capital den Sektor für sich entdeckt und pumpen beträchtliche Summen in hybride Klinik-Modelle und B2B-SaaS. Ein wesentlicher Machtfaktor sind mittlerweile die Corporate VCs der Industrie. Fressnapf dominiert mit seiner Beteiligungsgesellschaft die Früh- und Wachstumsphase strategisch, während Mars Petcare über seinen Arm Kinship massiv nach Europa drängt.

Der eigentliche Motor der Innovation liegt jedoch bei den Frühphasen-Motoren und Business Angels. Hier brillieren Köpfe wie Lukas Keindl, der als Gründer des US-Vorbilds Bond Vet nun aktiv sein Know-how und Kapital in die europäische Gründerszene pumpt, sowie spezialisierte Angel-Syndikate und Netzwerke wie der Auxxo Female Catalyst Fund, die gezielt diverse Gründungsteams in der Tiermedizin fördern.

Die Top-PetTech-Start-ups (Must-Watch)

Die nachfolgende Auswahl der Top Start-ups basiert auf einer strengen redaktionellen Analyse. Die zentralen Kriterien für die Aufnahme in dieses Ranking sind eine nachgewiesene Marktrelevanz durch messbares Praxis- oder Nutzerwachstum, ein hoher technologischer Reifegrad fernab reiner Konzeptphasen sowie das ausdrückliche Vertrauen namhafter Lead-Investoren. Um die aktuelle Innovationskraft des deutschen Ökosystems abzubilden, haben wir uns ausschließlich auf deutsche Start-ups konzentriert, deren Gründung im Jahr 2020 oder später erfolgte. Die Liste beleuchtet bewusst eine Diversität an Geschäftsmodellen, von B2B-Software über BioTech bis hin zu hybriden Versorgungskonzepten.

Rex

Das im Jahr 2021 von Julian Lechner und Jonathan Loesing gegründete Berliner Start-up Rex ist das aktuelle Paradebeispiel für moderne Tiermedizin. Rex kombiniert ein B2B/B2C-Hybrid-Modell und baut architektonisch anspruchsvolle, digital voll integrierte T Tierärzt*innenpraxen auf. Der USP liegt in der proprietären Praxismanagement-Software, die den Tierärzt*innen die Administration abnimmt, und der nahtlosen App-Experience für den Tierhalter. Das enorme Potenzial dieses Modells überzeugte Vorwerk Ventures, Picus Capital und weitere namhafte Investor*innen, die dem Unternehmen bereits zweistellige Millionenbeträge anvertrauten.

Filu

Ebenfalls angetreten, um den chronisch überlasteten Tierärzt*innenmarkt zu revolutionieren, ist das Münchner Start-up Filu. Gegründet 2022 von Anna Magdalena Naderer, Christian Köhler und Justus Buchen, positioniert sich das Unternehmen mit seinem Urgent-Care-Ansatz gekonnt zwischen klassischer Allgemeinpraxis und Notfallklinik. Die Kombination aus modernster Hardware vor Ort und smarten Tele-Triage-Prozessen im Hintergrund sorgt für eine extrem hohe Effizienz. Lead-Investoren wie DN Capital und YZR Capital haben das immense Skalierungspotenzial früh erkannt und die Expansionspläne befeuert.

mammaly

Im Bereich der D2C-Tiergesundheit setzt das 2020 in Köln von Stanislav Nazarenus und Alexander Thelen gegründete Start-up mammaly neue Standards. Das Geschäftsmodell basiert auf dem Direktvertrieb von hochwirksamen, mit Tierärzt*innen entwickelten Nahrungsergänzungsmitteln in Snackform. Der USP liegt in der tiefgreifenden Fokussierung auf das Mikrobiom von Hunden, um altersbedingte Beschwerden proaktiv zu lindern. Dieses datengetriebene und markenstarke Konzept sicherte mammaly unter anderem ein substanzielles Funding durch den spezialisierten VC Five Seasons Ventures.

PetLEO

Dieses 2020 in München von Karim Abdo und Bülent Hacioglu gegründete Unternehmen agiert als eine hochkomplexe B2B2C-Gesundheitsplattform. PetLEO verbindet Tierärzt*innen, Expert*innen und Haustierbesitzer*innen in einem geschlossenen, digitalen Ökosystem. Tierhalter*innen können Gesundheitsdaten verwalten, Giftköder-Warnungen erhalten und Termine buchen, während die Praxen selbst eine moderne Schnittstelle zur Kund*innenbindung erhalten. Das Start-up hat sich durch starke Partnerschaften mit Industrie und Versicherungen eine äußerst wehrhafte Marktposition als digitaler Alltagsbegleiter erarbeitet.

Hundeo

Dass man auch ohne massive externe Kapitalrunden im PetTech-Markt dominieren kann, beweist das 2020 von Enrico Bachmann in Berlin gegründete Start-up Hundeo. Das B2C-EdTech-Modell ist eine gamifizierte App für modernes Hundetraining. Der technologische USP ist die personalisierte, KI-gestützte Trainingsplanung, die sich dem Lernfortschritt des jeweiligen Tieres anpasst. Mit enormem organischem Wachstum und starker Nutzer*innenbindung gehört das gebootstrappte Hundeo zu den profitablen Vorzeige-Start-ups der App-Economy.

Nosh.bio

Obwohl nicht exklusiv für den Pet-Markt gegründet, rüttelt das 2022 von Tim Fronzek und Felipe Lino in Berlin ins Leben gerufene DeepTech-Start-up Nosh.bio die Tiernahrungsindustrie fundamental auf. Das B2B-Geschäftsmodell fokussiert sich auf die Herstellung von Alternativen Proteinen aus Pilzmyzel. Der technologische USP liegt in einem hocheffizienten Fermentationsprozess, der saubere, hochverdauliche und texturstarke Proteinquellen aus Pilzmyzel liefert. Als hochfunktionale „Clean-Label“-Zutat ermöglicht sie die Entwicklung erstklassiger, fleischfreier Tiernahrung – völlig ohne chemische Zusätze und ohne den massiven ökologischen Fußabdruck der konventionellen Fleischindustrie. Lead-Investor Earlybird unterstützt dieses zukunftsweisende BioTech-Modell.

TestBlu

Mit Gründung im Jahr 2022 in Potsdam bringt TestBlu echte Deep-Science in die tierärztliche Praxis. Das von Shahab Shoaei Matin geführte Geschäftsmodell ist ein KI-gestütztes B2B-SaaS-Produkt für Veterinärkliniken. Der USP des Unternehmens ist Deutschlands erster Bluttest zur Früherkennung von Krebs bei Hunden. Ein hochkomplexer Algorithmus analysiert Blutbilder auf Anomalien mit enormer Präzision. TestBlu positioniert sich als unverzichtbarer onkologischer Co-Pilot für Tierärzt*innen, um die diagnostische Sicherheit drastisch zu erhöhen.

AnimalChat

Die 2020 von Sebastian Wilkes und dem erfahrenen Tierarzt Dr. Heinrich Wilkes aus Borken gestartete B2B-Software AnimalChat hat das Problem der ineffizienten Kommunikation in Praxen radikal gelöst. Das Start-up bietet einen DSGVO-konformen, professionellen Messenger-Dienst speziell für Veterinär*innen und deren Klient*innen an. Der USP ist die nahtlose Integration von asynchroner Kommunikation und digitaler Wundverlaufskontrolle, ohne dass der Arzt bzw. die Tierärztin seine bestehende Praxissoftware austauschen muss. Dieses pragmatische, aber hochskalierbare Tool hat sich in hunderten Praxen als Standard etabliert.

Internationaler Ausblick & Fazit

Wer heute verstehen will, was morgen in Europa passiert, muss den Blick zwingend über den Tellerrand richten. Drei globale Makro-Trends werden den deutschen PetTech-Markt in Kürze massiv umwälzen. Aus den USA schwappt die Welle der Longevity-Pillen herüber, wo Start-ups bereits erste FDA-Zulassungen für Medikamente anstreben, die das biologische Altern von Hunden verlangsamen. Asien hingegen definiert den Standard für Hyper-Vernetzung neu: Hier sind smarte Katzentoiletten und vollautomatische, mit dem Smart-Home synchronisierte Futterautomaten, die Gesundheitsdaten in Echtzeit an den Tierarzt bzw. die -ärztin senden, bereits Massenmarkt. In Israel, dem weltweiten Hub für FoodTech, verschmilzt derweil AgriTech mit Tiernahrung. Kultiviertes Fleisch aus dem Labor für Premium-Tiernahrung steht dort nach der ersten regulatorischen Marktzulassung für Heimtierfutter in Großbritannien durch das Start-up Meatly endgültig vor dem globalen Durchbruch.

Das Fazit für 2026 ist eindeutig: Der Welpenschutz für Gründer*innen ist abgelaufen. PetTech ist ein knallhartes Business, das exzellente Unit Economics, tiefes regulatorisches Verständnis und echte technologische Alleinstellungsmerkmale verlangt. Investor*innen suchen heute nach Geschäftsmodellen, die reale Engpässe wie den Tierärzt*innenmangel lösen oder die Lebensspanne der Tiere durch harte Wissenschaft verlängern. Wer in diesem 20-Milliarden-Markt mitspielen will, muss beweisen, dass er/sie nicht nur Tiere liebt, sondern vor allem sein/ihr strategisches und technologisches Handwerk versteht.

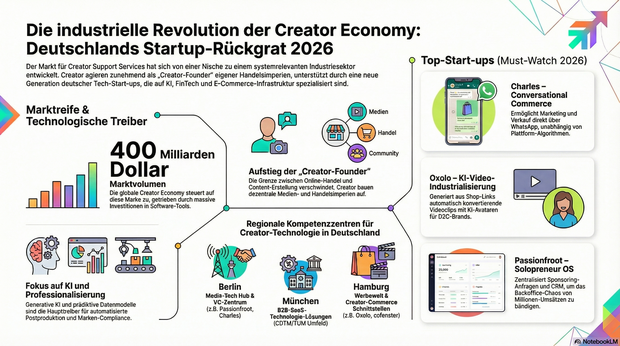

Start-up-Report: Creator Support Services

Die industrielle Revolution der Creator*innen ist in vollem Gange: Unser Report beleuchtet den boomenden Markt und zeigt die deutschen Tech-Start-ups, die das Rückgrat der neuen Medien-Champions bauen.

Wir erleben das Entstehen einer neuen ökonomischen Spezies: Der Creator-Founder. Die Grenze zwischen dem/der klassischen Online-Händler*in und dem/der modernen Content-Creator*in ist endgültig gefallen. Wer heute Reichweite besitzt, baut keine Community mehr auf, sondern ein dezentrales Medien- und Handelsimperium. Diese Transformation vom Nischenthema zur Systemrelevanz braucht jedoch eine industrielle Basis. Genau hier betritt eine neue Generation von Start-ups die Bühne. Diese „Werkzeugmacher*innen“ – spezialisiert auf KI-gesteuerte Produktion, autonome Analyse und FinTech – bilden das unsichtbare, hochprofitable Rückgrat einer Branche, die gerade ihre industrielle Revolution erlebt.

Das Ökosystem wird erwachsen

Die Marktlage im Jahr 2026 beweist eindrucksvoll, dass die Werkzeug-Infrastruktur für digitale Entrepreneur*innen den Kinderschuhen entwachsen ist. Laut aktuellen Hochrechnungen etablierter Investmentbanken steuert die globale Creator Economy unaufhaltsam auf die 400-Milliarden-Dollar-Marke zu, wobei ein signifikanter zweistelliger Prozentsatz direkt in Software- und Servicetools fließt.

Auch in Deutschland bestätigt der jüngste KfW-Gründungsmonitor diese Reife: Software-Lösungen für digitale Medienschaffende gehören zu den widerstandsfähigsten B2B-Segmenten der Post-Krisen-Ära. Der technologische Haupttreiber dieser rasanten Professionalisierung ist zweifellos die angewandte generative künstliche Intelligenz, dicht gefolgt von prädiktiven Datenmodellen. Deutsche Risikokapitalgeber*innen haben im vergangenen Jahr schätzungsweise über 350 Millionen Euro spezifisch in dieses Vertical gepumpt. Es geht längst nicht mehr um experimentelles Wagniskapital, sondern um Growth-Metriken und wiederkehrende SaaS-Umsätze in einem Markt, der eine beispiellose Professionalisierung erfährt.

Technologien der totalen Integration

Blickt man jenseits der offensichtlichen Dashboards, offenbaren sich die wahren Maschinenräume dieses Jahres. Drei Sub-Sektoren dominieren aktuell das Geschehen und treiben die Verschmelzung von Commerce und Content voran. Zunächst ist da die autonome KI-Postproduktion, bei der Algorithmen nicht nur schneiden, sondern selbständig Narrative für Verkaufsformate generieren.

Ein weiterer massiver Treiber ist die prädiktive Marken-Compliance. Hierbei handelt es sich um Legal-Tech-Lösungen, die vollautomatisiert Werbekennzeichnungspflichten und internationale Steuermodelle für Creator-Marken überwachen.

Schließlich etabliert sich das Creator FinTech, insbesondere durch umsatzbasierte Finanzierungsmodelle, die den dynamischen Cashflow von Influencer-Brands algorithmisch bewerten können. Während Pioniere der ersten Welle wie Linktree lediglich Brücken bauten, stoßen die aktuellen Akteure tief in diese hochkomplexen, technologischen Nischen vor, um den Creator*innen als vollwertigen E-Commerce-Akteur*innen zu befähigen.

Reality Check: Der Kater nach dem Hype

Dass diese Branche jedoch kein automatischer Garant für Einhörner ist, bewies der spektakuläre Crash der Web3-Creator-Plattformen um das Jahr 2023. Hochgelobte Projekte wie BitClout verbrannten Hunderte Millionen Dollar an Risikokapital, weil sie die Usability vernachlässigten und keinen echten Nutzwert jenseits der Spekulation boten. Aus diesem schmerzhaften Reality Check lassen sich vier fatale Fallstricke für heutige Gründer*innen ableiten. Der erste Fehler ist das API-Klumpenrisiko, also die blinde Abhängigkeit von den Launen großer Plattformen wie Meta oder YouTube. Ein zweites, oft tödliches Problem sind katastrophale Unit Economics bei Tools, die nur den nicht-monetarisierbaren "Long Tail" der Hobby-Nutzer*innen bedienen. Der dritte Fallstrick ist die chronische Unterschätzung der Regulatorik, insbesondere des EU AI Acts. Das vierte Learning betrifft den Technologie-Fetischismus: Wer Lösungen aufzwingt, die technologisch brillieren, aber in der alltäglichen User Experience der Creator*innen versagen, wird vom Markt gnadenlos abgestraft.

Deutschlands heimliche Creator-Hubs

Die architektonische Landkarte der deutschen Creator-Tool-Landschaft konzentriert sich 2026 auf hochspezialisierte Hotspots. Berlin bleibt der unangefochtene Magnet, angetrieben von einer dichten Konzentration an Media-Tech-VCs und der Strahlkraft von Kaderschmieden wie der ESMT. München agiert als das kraftvolle Gegenstück für harte Technologiebedingungen. Angefacht durch das CDTM und die TU München, entstehen hier vor allem datenlastige B2B-SaaS-Produkte für die Industrie. Das Rheinland, spezifisch die Achse Aachen und Köln, fungiert als historisch gewachsenes Cluster, das auf dem Fundament klassischer TV-Produktionen und starken Informatik-Fakultäten wie der RWTH Aachen basiert. Abgerundet wird dieses Netzwerk durch Hamburg. Die Hansestadt nutzt ihre tiefe Verwurzelung in der Werbe- und Agenturwelt sowie Netzwerke wie den Next Media Accelerator, um Tools zu entwickeln, die genau an der Schnittstelle zwischen Markenbudgets und der Creator-Commerce-Welt ansetzen.

Investor*innen-Radar

Ein genauer Blick auf die Geldgeber*innen offenbart, wer das Benzin für diese Maschine liefert. Bei den spezialisierten VCs haben Akteure wie Creator Ventures den Takt vorgegeben, während in Deutschland vor allem Vehikel rund um OMR Ventures den tiefen Brancheneinblick für Seed-Finanzierungen nutzen. Auf der Ebene der Top-Tier Generalisten sehen wir Fonds wie Creandum, Cherry Ventures und Point Nine, die ihre rigorosen B2B-SaaS-Metriken nun konsequent auf Creator-Tools anwenden. Die Industrie mischt über Corporate VCs ebenfalls kräftig mit; hier sichern sich Bertelsmann Investments oder SevenVentures strategische Marktanteile, um ihre eigenen Wertschöpfungsketten zu digitalisieren. Der eigentliche Motor der Frühphase sind jedoch die Business Angels und Syndikate. Hier agieren Digitalgrößen wie Philipp Westermeyer oder Prominente wie Mario Götze als strategische Türöffner, die den Start-ups unmittelbaren Zugang zu jener Creator-Elite verschaffen, die heute die Märkte bewegt.

Die Top Start-ups (Must-Watch 2026)

Die für diesen Report ausgewählten Start-ups wurden anhand einer rigorosen Analyse ihrer Marktrelevanz im Jahr 2026, ihres technologischen Reifegrades sowie der Stabilität ihrer Geschäftsmodelle bewertet. Ein wesentliches Kriterium war zudem das Investoren-Vertrauen durch namhafte Risikokapitalgeber. Wir betrachten ausschließlich Unternehmen mit Hauptsitz in Deutschland, die ab dem Jahr 2020 gegründet wurden, um den aktuellen Innovationszyklus der "Post-Plattform-Ära" präzise abzubilden – jene Ära, in der Creator zu echten Handelsmarken werden.

Passionfroot (Gegründet 2021)

Das Team um Jennifer Phan, Jens Willemen und Michelle Tian hat von Berlin aus einen globalen Standard gesetzt. Ihr B2B-SaaS-Modell bietet einen ganzheitlichen Workspace, der Sponsoring-Anfragen und CRM für Creator zentralisiert. Der USP ist die radikale Vereinfachung des Backoffice-Chaos für jene „Solopreneur*innen“, die heute Millionenumsätze verwalten. Namhafte VCs wie Creandum und Cherry Ventures investierten hier in einer Seed-Runde 3 Millionen Euro in Passionfroot.

Nindo (Gegründet 2020)

Gegründet von Rezo und Tim Jacken in Aachen, ist Nindo der Inbegriff für den Sprung von Content-Expertise zu tiefen B2B-Data-SaaS-Lösungen. Das Unternehmen bietet granularste Analytics und Reichweiten-Validierungen für das Influencer-Marketing. Durch den Einstieg und die strategische Partnerschaft mit dem globalen Medienhaus Webedia stützt Nindo heute maßgeblich das Wachstum jener Marken, die auf datenbasierte und verifizierte Creator-Kooperationen setzen.

cofenster (Gegründet 2020)

Die Hamburger Gründer Tom Vollmer, Oliver Wegner und Finn Frotscher adressieren die „Corporate Creator Economy“. Ihr Tool ermöglicht es Unternehmen, Mitarbeiter-Content via KI-Guidance in professionelle Verkaufs- und Info-Videos zu verwandeln. Dieser Ansatz sicherte cofenster unter anderem eine Seed-Finanzierung in Höhe von 1,5 Millionen Euro, angeführt von Capnamic Ventures.

Charles (Gegründet 2020)

Artjem Weissbeck und Andreas Tussing bringen mit Charles Conversational Commerce nach Berlin. Ihr SaaS-Modell erlaubt es E-Commerce- und Creator-Brands, Marketing und Verkauf vollständig über WhatsApp abzuwickeln. Der USP liegt in der direkten Monetarisierung ohne Algorithmus-Abhängigkeit, was Salesforce Ventures im Rahmen einer Series-A-Runde zu einem Investment von 20 Millionen Dollar veranlasste.

Wonnda (Gegründet 2022)

Das Berliner Duo Martin Ditzel und Oliver Allmoslechner schließt die Lücke zwischen digitaler Reichweite und physischem Handel. Als B2B-Marktplatz verbindet Wonnda Creator*innen mit europäischen Hersteller*innen für Eigenmarken. Die Plattform digitalisiert das Sourcing und zementiert den Trend zum „Creator-as-a-Manufacturer“, finanziert von namhaften Frühphasen-VCs wie Pitchdrive.

Oxolo (Gegründet 2020)

Das Hamburger Team um Elisabeth L’Orange und Heiko Hubertz besetzt die entscheidende Schnittstelle, an der 2026 die Grenze zwischen klassischem E-Commerce und Creator-Content endgültig verschwindet. Ihr „URL-to-Video“-Modell generiert aus schlichten Shop-Links hochgradig konvertierende Videoclips mit KI-Avataren. Dass Oxolo primär von „Sellern“ spricht, ist ein strategisches Understatement: In Wahrheit nutzen vor allem Creator-Founders das Tool, um ihre D2C-Brands zu industrialisieren. Mit einer Series-A-Finanzierung von 13 Millionen Euro (Lead: DN Capital) ist Oxolo der unsichtbare Motor hinter dem kommerziellen Erfolg moderner Creator-Marken.

Moojo (Gegründet 2021)

Das Berliner Start-up von Amir Djouadi, Christian Engnath und Utena Treves fungiert als das finanzielle Rückgrat der dezentralen Wirtschaft. Moojo bietet eine integrierte FinTech-Lösung, die Rechnungsstellung und sofortige Auszahlungen für Creator*innen automatisiert. Durch die Reduzierung von Zahlungsverzögerungen löst das Start-up eines der größten Liquiditätsprobleme der Branche, unterstützt durch ein 2-Millionen-Dollar-Pre-Seed-Funding von b2venture und APX.

ZebraCat (Gegründet 2022)

Reza Zolfaghari und Michael Baumgartner konzentrieren sich mit ZebraCat in Berlin auf die „Prompt-to-Video“-Revolution. Ihr Modell ermöglicht es Creator*innen, durch einfache Textbeschreibungen komplexe Video-Narrative inklusive Schnitt zu generieren. Als Absolventen von Entrepreneur First verkörpern sie die neue Generation von KI-Tools, die den kreativen Prozess radikal beschleunigen.

Internationaler Ausblick & Fazit

Der Blick auf die globale Makroebene zeigt, dass die europäische Creator Economy erst am Anfang einer tiefgreifenden Umwälzung steht. Aus Asien schwappt die nächste Evolutionsstufe der Live-Commerce-Infrastruktur herüber, während in den USA autonome KI-Agenten bereits die Verhandlungen komplexer Marken-Deals übernehmen. Für den europäischen Markt bedeutet dies: Wer heute noch isolierte Content-Tools baut, wird den Anschluss an den Handel verlieren. Die Zukunft gehört jenen Plattformen, die den gesamten Workflow vom ersten Frame bis zum finalen Checkout digitalisieren.

Das Fazit für Gründer*innen und Investor*innen: Die Creator Economy ist kein flüchtiger Trend mehr, sondern das Betriebssystem des modernen Mittelstands. Wer die Souveränität über die eigene Technologie und die eigenen Daten besitzt, wird die Medienhäuser und Handelskonzerne von morgen führen.

NBH-Systems: Zwischen Schaltschrank und Skalierbarkeit

Wie Dorian Tobollik und Timo Hartig mit ihrem Hardware-Start-up NBH-Systems eine Industrie-Nische knacken wollen.

Laptops, die prekär auf Maschinengehäusen balancieren, oder kniende Instandhalter*innen, die notgedrungen mit einer Hand tippen – der Arbeitsplatz im technischen Service ist selten ergonomisch. Aus genau diesem alltäglichen „Pain Point“ heraus ist das Start-up NBH-Systems entstanden. Wie Dorian Tobollik und Timo Hartig mit ihrem Hardware-Unternehmen eine Industrie-Nische knacken wollen, haben wir analytisch unter die Lupe genommen.

Vom Pain Point zum Produkt

Die Entstehungsgeschichte des hessischen Start-ups ist ein klassisches Lehrstück für anwendergetriebene Innovation. Dorian Tobollik, selbst langjähriger Systemtechniker, erlebte das Fehlen eines stabilen Arbeitsplatzes an Maschinen und Anlagen immer wieder als echten Effizienz- und Sicherheitskiller. Anstatt den Status quo hinzunehmen, ging er ans Reißbrett und entwickelte eigene Prototypen.

Doch der Weg zur Serienfertigung „Made in Germany“ barg Tücken. „Der Weg vom ersten Prototyp bis zur Serienfertigung war deutlich aufwendiger, als ich am Anfang gedacht habe“, räumt Tobollik rückblickend ein. Der große Vorteil lag jedoch in seiner eigenen Berufspraxis: „Die Idee kam direkt aus meinem Arbeitsalltag als Servicetechniker. Ich habe das Produkt selbst täglich im Einsatz gehabt, konnte es direkt testen und immer wieder anpassen.“

Die Teufel steckten bei der Umsetzung im Detail – von Gewicht und Größe über die Kompatibilität der Notebook-Formate bis hin zur exakten Stärke der Magnete. „Das sind Dinge, die man nicht am Schreibtisch löst, sondern nur im Alltag“, betont das technische Gehirn des Duos. Aus purer Überzeugung ließ er den vielversprechenden Ansatz direkt patentieren.

Um aus der funktionalen Erfindung ein marktfähiges Unternehmen zu formen, stieß Timo Hartig dazu. Er verantwortet als Geschäftsführer den Vertrieb und das Marketing, während Tobollik sich auf die Produktentwicklung fokussiert. Ende 2025 mündete dies in der Gründung der NBH-Systems UG im hessischen Seligenstadt.

Die Arbeitsteilung ist scharf getrennt, was unweigerlich die Frage nach internen Konflikten zwischen technischer Perfektion und straffen Vertriebszielen aufwirft. Hartig gibt sich hier pragmatisch: „Natürlich gibt es diesen klassischen Zielkonflikt zwischen technischer Perfektion und Marktdruck – aber wir lösen das sehr praxisnah. Für uns steht immer der reale Einsatz im Vordergrund.“ Die Entwicklungszyklen bleiben dabei extrem kund*innennah. Bis heute verzeichnet das Unternehmen laut dem Geschäftsführer keine einzige Retoure oder Reklamation. Neue Ansätze werden bewusst strukturiert angegangen und vorab mit ausgewählten Kund*innen getestet. „Am Ende entscheidet immer die Praxis. Wenn eine Lösung robust, einfach und zuverlässig funktioniert, ist sie marktfähig – und genau darauf liegt unser Fokus“, resümiert Hartig. Bootstrapping pur: Das Duo finanziert das Projekt vollständig selbst, produziert bewusst in Deutschland, arbeitet parallel in anderen Jobs und reinvestiert jeden verdienten Euro in die Firma.

Hardware-Fokus mit B2B-Preisschild

Das Kernprodukt nennt sich „MagFlex Pro“ – eine Notebook-Halterung, die werkzeuglos per Magnet oder industrieller Saugglocke an glatten Flächen oder Maschinen haftet. Mit einem Verkaufspreis von knapp 250 Euro und lokaler Fertigung platziert sich NBH-Systems selbstbewusst im B2B-Premium-Segment. Ein smarter Vertriebshebel: Ab zehn Stück gibt es Anpassungen im Corporate Design, was erfahrungsgemäß die Hemmschwelle für größere Flottenbestellungen senkt.

Doch das reine Hardware-Geschäft ist aus betriebswirtschaftlicher Sicht tückisch. Es gibt im Vergleich zur Softwarebranche keine stetigen Abo-Umsätze, das bewusst langlebige Produkt limitiert das lukrative Ersatzgeschäft, und die Skalierung erfordert hohe Vorfinanzierungen. Auf den kontinuierlichen Neukund*innendruck angesprochen, bestätigt Hartig die strategische Herausforderung: „Uns ist bewusst, dass ein reines Hardware-Geschäft kontinuierlich neue Kunden erfordert. Genau deshalb liegt unser aktueller Fokus klar auf Sichtbarkeit, Markenaufbau und darauf, unsere Lösung am Markt zu etablieren.“

Die Strategie im zu 90 Prozent B2B-getriebenen Kund*innenstamm setzt primär auf klassische Kanäle wie Direktvertrieb und den Ausbau von Großhändler*innen. Ein modulares Ökosystem entsteht dabei behutsam und streng nach Kund*innenwunsch: „Darauf aufbauend entwickeln wir Zubehör und Erweiterungen gezielt aus dem tatsächlichen Bedarf heraus. Für uns steht nicht Cross-Selling im Vordergrund, sondern ein echter Mehrwert im Einsatz.“ Auf das modische Schlagwort „Hardware-as-a-Service“ für Großkund*innen reagiert der Geschäftsführer noch zurückhaltend. Perspektivisch seien solche Modelle denkbar, aktuell zähle aber der Ausbau einer soliden Marktbasis im B2B-Umfeld.

Markt & Wettbewerb: Die Macht der Gewohnheit

Der anvisierte Markt für Außendienst- und Instandhaltungstechniker ist spitz, aber tief – nicht zuletzt, weil der chronische Fachkräftemangel die Budgets für Arbeitssicherheit und Effizienz lockert. Der härteste Konkurrent ist oft jedoch paradoxerweise kein globales Konkurrenzprodukt, sondern die blanke Improvisation. Wie knackt man also das Mindset von B2B-Einkäufer*innen, die für etwas zahlen sollen, das früher eine kostenlose (wenn auch wackelige) Kiste oder Ablagefläche erledigte?

„Die größte Herausforderung im Vertrieb ist tatsächlich weniger der Wettbewerb durch andere Anbieter, sondern die bestehende Gewohnheit. Viele Unternehmen haben sich über Jahre mit improvisierten Lösungen arrangiert“, weiß Hartig. Der stärkste Vertriebskanal des Start-ups ist daher das Produkt selbst, passend zum Slogan „Work Hands Free“. „In der Praxis steht ein Techniker am Schaltschrank oder an der Maschine, arbeitet mit dem MagFlex Pro – und Kollegen oder andere Beteiligte sehen das direkt“, erklärt Hartig den viralen Effekt am Einsatzort. Ein QR-Code auf der Halterung führt direkt zur Unternehmenswebsite, wodurch der Bedarf beim Anwender geweckt und in der Folge intern an den Einkauf weitergegeben wird.

Den exakten „Return on Investment“ (ROI) durch eingesparte Rüstzeiten datenbasiert zu beziffern, fällt dem Start-up hingegen schwer. Hartig räumt ein, dass sich Effekte wie strukturiertes Arbeiten und reibungslosere Abläufe nicht immer exakt in Zahlen pressen lassen. Dennoch sehe man in der Praxis, dass die Firmen zunehmend bereit sind, in solche Arbeitsbedingungen zu investieren.

Gegenüber globalen Giganten wie RAM Mounts und asiatischen Billigimporten muss NBH-Systems seinen USP – die authentische Historie von Technikern für Techniker gepaart mit der lokalen Produktion – daher als zwingendes Differenzierungsmerkmal glasklar nach außen kommunizieren.

Fazit: Solider Hidden Champion statt VC-Unicorn

NBH-Systems ist ein reinrassiges „Painkiller“-Start-up. Es löst ein reales, akutes Problem am Arbeitsplatz, anstatt als bloßes „Nice-to-have“ zu glänzen. Da Software-Komponenten oder Abo-Modelle fehlen, fehlt auch der klassische Hebel für exponentielles Hyperwachstum, der Venture-Capitalisten anlockt.

Das scheint das Gründer-Duo jedoch keineswegs zu stören. Sie wollen sich langfristig als Standard-Ausrüster in den Werkzeugkoffern großer Service-Flotten verankern und ein bodenständiges, hochprofitables KMU aufbauen. „Unser Fokus liegt klar auf einem soliden, nachhaltig wachsenden Unternehmen im B2B-Bereich. Wir bauen bewusst ein praxisorientiertes Hardware-Business auf und sehen uns nicht als klassisches Venture-Capital-Start-up“, unterstreicht Hartig die eigenen Ambitionen.

Man verkaufe derzeit vor allem im DACH-Raum sowie in den Niederlanden und Frankreich, peile aber als großen nächsten Schritt die weitere Internationalisierung an. Digitale Zukunftsfantasien für den Weg zum Industrie-Schwergewicht schließt er für später dennoch nicht aus: „Das bedeutet nicht, dass wir Themen wie IoT oder digitale Erweiterungen grundsätzlich ausschließen. Aktuell liegt unser Fokus aber klar darauf, unser bestehendes Produkt weiterzuentwickeln und weitere Anwendungsbereiche zu erschließen.“

KI gegen Buchhaltungsriesen: Wie Bonster den Spesen-Markt aufmischen will

Pay-per-Use statt Abo-Falle: Das Oldenburger Start-up fast2work attackiert mit seiner App bonster komplexe Software-Giganten. Doch reicht das Versprechen maximaler Einfachheit im Haifischbecken der FinTechs? Wir haben nachgehakt.

Es ist eines der letzten großen Ärgernisse im Arbeitsalltag von Freelancer*innen und kleinen Agenturen: Der Freitagabend, der für das Sortieren verknitterter Tankbelege und das Abtippen von Bewirtungsbelegen in Excel-Listen draufgeht. Genau hier setzt die Oldenburger fast2work GmbH mit ihrer am 17. Februar 2026 gelaunchten App bonster an, um den Papierkram bei der Reisekostenabrechnung zu beenden. Das Versprechen von Gründer und CEO Ronald Bankowsky: Drei Minuten Aufwand, KI-Automatisierung und keine Einstiegshürden.

Das Versprechen: Simpel statt Systemintegration

Die Funktionsweise der App ist bewusst minimalistisch gehalten: Beleg fotografieren, woraufhin die KI relevante Werte wie Datum, Betrag und Mehrwertsteuer ausliest, auf Duplikate prüft und eine fertige Abrechnung erstellt. „Kein Onboarding-Projekt, kein Vertriebsgespräch, kein IT-Setup“, fasst Bankowsky den Ansatz der Standalone-Lösung zusammen.

Die Zielgruppe ist klar definiert: Selbständige, Freelancer*innen und Mini-Teams, denen Enterprise-Lösungen wie SAP Concur zu mächtig und Start-ups wie Circula oder Pleo oft noch zu prozesslastig sind. Mit einem Preismodell von 1,99 Euro für Einzelabrechnungen und 6,99 Euro (Stand Ende Febr. 2026) für eine Flatrate positioniert sich das Unternehmen im unteren Preissegment.

Im Haifischbecken der Neobanken und Buchhaltungsriesen

Laut fast2work gab es bislang „kaum eine Alternative zwischen Excel und Enterprise-Software“. Diese Aussage hält einem Realitätscheck im Jahr 2026 allerdings nur bedingt stand. Bonster betritt ein Haifischbecken, denn die vermeintliche Lücke wird längst geschlossen.

Zum einen integrieren Buchhaltungsriesen wie Lexoffice oder sevDesk Reisekosten-Features immer tiefer in ihre Standardpakete. Zum anderen wildern Neobanken wie Qonto, Finom oder Kontist im selben Revier: Wer dort ein Geschäftskonto hat, bekommt die Belegzuordnung oft als „Commodity“ gratis dazu. Mit knapp 7 Euro im Monat bewegt sich bonster in einer Preisregion, in der man fast schon eine komplette einfache Buchhaltungssoftware bekommt. Die App muss also einen enormen Mehrwert bieten, um gegen die „Eh-da-Lösungen“ (Software, die Kund*innen ohnehin bezahlen) zu bestehen.

Auf die Frage, warum Freelancer*innen für eine Insellösung extra zahlen sollten, entgegnet der Gründer, dass bonster bewusst früher ansetze als klassische Tools. Das Hauptproblem sei nicht die Buchhaltung, sondern das Erfassen von Belegen unterwegs. „Genau dort scheitert es oft, weil Mitarbeitende keine komplexen Systeme nutzen wollen oder gar keine Zugänge haben“, argumentiert Bankowsky. Der Mehrwert liege nicht in einer weiteren Buchhaltungssoftware, sondern darin, dass durch die Reduzierung auf ein Foto „überhaupt verwertbare Abrechnungsdaten/Belege entstehen“.

Kritische Faktoren: GoBD und Datensicherheit

Neben der Marktpositionierung ist die Rechtssicherheit ein kritischer Faktor. „Fertige Abrechnung für die Buchhaltung“ ist ein mutiges Versprechen, da in Deutschland ein Foto allein oft nicht ausreicht; es muss GoBD-konform und revisionssicher archiviert werden. Zudem ist die KI-Nutzung datenschutzrechtlich sensibel. Wenn Bewirtungsbelege, die offenbaren, mit wem man gegessen hat, über US-Schnittstellen (z.B. OpenAI) fließen, ist das für deutsche Geschäftskund*innen und Steuerberater oft ein K.O.-Kriterium.

Auf die sensiblen Vorgaben der Finanzämter und den Serverstandort angesprochen, betont Bankowsky, dass die Verarbeitung „ausschließlich auf europäischen Servern“ erfolge. Zwar nutze man OpenAI-basierte Modelle, diese liefen jedoch über Azure-Rechenzentren im europäischen Raum. Datenschutz und regulatorische Anforderungen seien Grundvoraussetzung. Auch beim Export zum Steuerberater zeigt sich der Gründer zuversichtlich: Buchhaltungssysteme könnten die Daten direkt und „ohne manuelle Nacharbeit“ weiterverarbeiten.

Beta-Test als Exklusiv-Club

Zum Start setzt das Unternehmen auf eine Gamification des Rollouts. Die ersten 500 Nutzer*innen erhalten im „Club 500“ einen lebenslangen Rabatt von 50 Prozent. Was als Belohnung für Early Adopters verkauft wird, ist strategisch notwendig: Die KI muss lernen. Der Algorithmus braucht dringend „Real World Data“ – echte, verknitterte, schlecht beleuchtete Belege. Das bedeutet auch: Die ersten User*innen sind Teil des Entwicklungsprozesses.

Dass die App im Alltag noch dazulernen muss, räumt Bankowsky ein. Bei der reinen Datenerkennung sei man technisch auf dem aktuellen Stand. „Entscheidend ist jedoch die Qualität realer Belege im Alltag – etwa schlecht fotografierte oder handschriftliche Quittungen“, erklärt er den Bedarf an Praxis-Feedback. Durch schnelle Updates solle die Genauigkeit für alle Nutzer*innen laufend steigen.

Gegenmodell zur Ökosystem-Abhängigkeit

Wer ein Feature-Feuerwerk suche, werde bei bonster enttäuscht sein – was laut Unternehmen aus Überzeugung geschehe. Anbieter wie Rydoo verfolgten eine Strategie der maximalen Integration und langfristiger Verträge, was eine Abhängigkeit erzeuge, die ihr eigentliches Geschäftsmodell sei, so der Gründer. Wer einmal im Ökosystem stecke, wechsle nicht mehr, weil der Ausstieg zu teuer geworden sei.

Bonster positioniert sich als Gegenmodell für Unternehmen, die nicht für ungewollte Komplexität zahlen möchten: Kein Vertrag, keine Mindestnutzerzahl, Setup in unter fünf Minuten und ein Pay-per-Use-Modell. „Wer aufhören will, hört auf, ohne Konsequenzen“, beschreibt das Start-up den Ansatz der bewussten Entscheidung, Kund*innen freizulassen. Wer bleibe, tue dies, weil es funktioniere, was laut Bankowsky „die interessantere Innovation“ sei.

Fazit

Bonster ist ein innovativer Angriff auf die Zettelwirtschaft und wirkt durch den Verzicht auf starre Abo-Modelle bei der Einzelabrechnung fair. Doch die App steht und fällt mit der Schnittstellenkompetenz. Wenn der Export zu DATEV & Co. hakt, wird aus der Zeitersparnis schnell Mehrarbeit. Bonster muss beweisen, dass es die Brücke zwischen dem schnellen Foto und der strengen deutschen Buchhaltung schlagen kann – und zwar besser als die Banken, die das Feature bereits kostenlos anbieten.

Better Sol: Zweites Leben für die Solarwende

Wie das 2023 von Mirko Laube und Luisa Schulze gegründete Start-up Better Sol den PV-Gebrauchtmarkt aufmischen will.

Das Braunschweiger Start-up Better Sol erhält rund 125.000 Euro Förderung aus dem „Green Startup“-Programm der Deutschen Bundesstiftung Umwelt (DBU), um gebrauchte Solarpaneele in großem Stil zurück in den Markt zu bringen.

Hinter dem Start-up stehen Luisa Schulze und Mirko Laube. Better Sol entstand ursprünglich im Sommer 2022 als Ausgründung des Magdeburger Recycling-Unternehmens Solar Materials und agiert seit 2023 als eigenständige GmbH am Standort Braunschweig. Während sich die ehemalige Muttergesellschaft auf das komplexe werkstoffliche Recycling von Modulen konzentriert, widmet sich Better Sol voll und ganz dem „Second Life“ – also der direkten Wiederverwendung der noch intakten Platten.

KI-gestützte Prüfung statt Schredder

Die Beschaffungsseite von Better Sol zielt primär auf große Solarparks ab. Die Betreiber tauschen dort häufig größere Mengen an Solarmodulen recht früh in ihrem Lebenszyklus durch neuere, leistungsstärkere Modelle aus. Um diese Module vor dem Müll zu bewahren, hat das Better-Sol-Team mittels DBU-Förderung ein in Teilen automatisiertes Testsystem mit eigener Software auf Basis künstlicher Intelligenz (KI) entwickelt.

Der Prüfprozess beginnt mit einer mehrstufigen optischen Untersuchung, bei der sowohl grobe Beschädigungen als auch jede Solarzelle einzeln begutachtet werden. Im Anschluss folgen eine eingehende Prüfung der elektrischen Sicherheit sowie eine Leistungsüberprüfung, die misst, wie viel Watt das Produkt im Vergleich zur ursprünglichen Leistung noch liefert. Die Software führt all diese Daten automatisiert zu einer detaillierten Leistungsprognose zusammen. Jedes funktionstüchtige Modul erhält ein Label mit den Testdaten, einer zugewiesenen Leistungsklasse und einem umfangreichen Prüfprotokoll. Nur der endgültige Rest wird zum Recycling aussortiert. Der Vertrieb erfolgt direkt über die Internetseite von Better Sol. Zielgruppe sind oft Privathaushalte oder die Dächer größerer Fabrikhallen.

Der Markt und die Technologie im Wettbewerbsvergleich

Nach Angaben des Statistischen Bundesamtes verbucht die Photovoltaik mittlerweile einen Anteil von etwa 24 Prozent und ist damit der zweitwichtigste Energieträger der inländischen Stromerzeugung. Das Reservoir an ausgemusterten, aber noch funktionierenden Modulen wächst rasant. Laut Schulze ist im Schnitt jedes zweite gebrauchte Solarmodul noch für eine erneute Nutzung geeignet. Doch der Gebrauchtmarkt professionalisiert sich zusehends.

Better Sol setzt aktuell auf eine pragmatische, KI-gestützte Teilautomatisierung und plant als nächsten logischen Entwicklungsschritt eine mobile Testanlage, um die Solarmodule direkt dort zu testen, wo sie ausgemustert werden. Genau in diesem logistisch entscheidenden Bereich der Vor-Ort-Prüfung operiert bereits der etablierte Wettbewerber 2ndlifesolar, eine Marke der großen Buhck Gruppe. 2ndlifesolar greift auf ein deutschlandweites Logistiknetzwerk zurück und kombiniert stationäre Erstbehandlungsanlagen mit mobilen Prüflaboren. Technologisch geht das Unternehmen tief in die industrielle Qualitätssicherung und führt standardmäßig Elektrolumineszenz-Prüfungen durch, um unsichtbare Mikrorisse im Vorfeld zu detektieren.

Einen völlig anderen, stark hochskalierten Weg bestreitet das österreichische CleanTech-Start-up 2nd Cycle. Das Unternehmen betreibt eine vollautomatische Inspektions- und Upcycling-Anlage im industriellen Hochdurchsatz und nutzt neben klassischer Robotik auch patentierte hyperspektrale Analysen aus der Raumfahrt, um Zellalterungen frühzeitig zu erkennen.

Der Schlüssel zum wirtschaftlichen Erfolg

Das Vorhaben von Better Sol leistet einen fundamentalen Beitrag, um noch leistungsfähige Materialien durch geschickte Kreislaufwirtschaft für eine Weiternutzung zu erhalten, damit die Bemühungen für mehr erneuerbare Energien nicht ins Stocken geraten. Dennoch muss sich das Geschäftsmodell in einem harten Wettbewerb beweisen.

Die Handwerkerkosten für den Aufbau einer PV-Anlage auf einem Eigenheim sind hoch und fallen völlig unabhängig davon an, ob man neue oder gebrauchte Paneele installiert. Gleichzeitig steht der Markt unter enormem Preisdruck durch historisch günstige asiatische Neuware. Wenn fabrikneue Module extrem billiger werden, schwindet das Argument der finanziellen Ersparnis bei Gebrauchtmodulen mit kürzerer Restlebensdauer. Der Schlüssel zum wirtschaftlichen Erfolg von Better Sol liegt daher in der rigorosen Minimierung der eigenen Logistik- und Prozesskosten. Die geplante mobile Testanlage und die zusätzliche Automatisierung des Testsystems sind für das Start-up essenziell, um künftig auch größere Ausmusterungen von Solarparks wirtschaftlich bewältigen zu können.

Mio.-Funding und leergekaufte Lager: Die Entwicklung des BioTech-Start-ups PerioTrap

Ein selektiver Wirkstoff gegen Parodontitis, ausverkaufte Zahnpasta-Bestände und frisch eingesammelte 2,9 Mio. Euro: Das BioTech-Start-up PerioTrap verzeichnet derzeit ein starkes Momentum. Doch wie tragfähig ist das Geschäftsmodell? Eine Analyse zwischen wissenschaftlicher Innovation, Crowdinvesting-Strategie und zahnmedizinischer Realität.

Das Timing war für PerioTrap günstig. Als die Fraunhofer-Gesellschaft Anfang 2026 eine Mitteilung über den neuartigen Wirkstoff des Start-ups gegen Parodontitis veröffentlichte, war das Medienecho groß. Die Folge: Die neu gelaunchte Mikrobiom-Zahnpasta des Unternehmens war innerhalb von zwölf Stunden ausverkauft. Auf diesen kommerziellen Soft-Launch folgte nun der finanzielle Nachschlag. Laut den offiziellen Angaben der Crowdinvesting-Plattform Companisto flossen in der aktuellen Finanzierungsrunde insgesamt 2,9 Millionen Euro in die Kassen, getragen vom Business-Angel-Netzwerk Companisto sowie einem Co-Investment der bmp Ventures (IBG-Fonds). Doch was macht PerioTrap für Anleger so interessant?

Von der Petrischale zum Produkt

Die Wurzeln von PerioTrap reichen bis ins Jahr 2013 zurück. Damals begann die Erforschung des Parodontitis-Erregers Porphyromonas gingivalis im Rahmen des internationalen, EU-geförderten Forschungskonsortiums TRIGGER. Treibende Kraft war der Pharmazeut Dr. Mirko Buchholz, der mit über 25 Jahren Erfahrung in der Wirkstoffentwicklung den Kern der heutigen Technologie erfand. 2019 folgte gemeinsam mit dem Wirtschaftsexperten Pierre Tangermann (heute CEO) die offizielle Ausgründung aus dem Fraunhofer-Institut für Zelltherapie und Immunologie (IZI) am Weinberg Campus in Halle (Saale).

Die Arbeitsteilung der Gründer ist klassisch: Buchholz fungiert als wissenschaftlicher Kopf (CSO), Tangermann übersetzt die Forschung als CEO in eine für Investor*innen verständliche „Equity Story“. Spätestens mit dem Gesamtsieg beim IQ Innovationspreis Mitteldeutschland im Jahr 2020 erlangte das Duo überregionale Sichtbarkeit, die konsequent für die Kapitalsuche genutzt wurde.

Modulation statt Breitbandwirkung

Der Markt, auf den PerioTrap zielt, ist groß. Parodontitis ist eine weit verbreitete Erkrankung; laut der repräsentativen Deutschen Mundgesundheitsstudie (DMS) leidet mehr als die Hälfte der Erwachsenen zwischen 35 und 44 Jahren an einer moderaten oder schweren Form. Die bisherigen Branchenstandards setzen meist auf Breitbandantibiotika oder Antiseptika wie Chlorhexidin. Das Problem dieser Lösungen: Sie greifen das gesamte orale Mikrobiom an und reduzieren auch die nützlichen Bakterien. Bei der Regeneration sind die aggressiven Parodontitis-Erreger oft schneller als die gesunden Bakterien – ein medizinischer Teufelskreis.

PerioTrap setzt stattdessen auf Selektivität. Nach Unternehmensangaben hemmt der patentierte Wirkstoff gezielt ein Enzym (die bakterielle Glutaminylcyclase) des Leitkeims P. gingivalis. Die krankmachenden Eigenschaften des Erregers sollen so blockiert werden, ohne das restliche Mikrobiom anzugreifen. Neben der frei verkäuflichen Zahnpasta für Endkund*innen positioniert das Start-up auch ein professionelles Pflege-Gel für die zahnärztliche Praxis. Zukünftig sollen Haustiere als weiterer Markt erschlossen werden.

Innovation oder ergänzendes Präparat?

Bei aller positiven Resonanz im Crowdinvesting darf das Geschäftsmodell kritisch eingeordnet werden: