Aktuelle Events

Zip2 - Elon Musks erstes Startup

Wie Elon Musk sein erstes Start-up Zip2 gründete

Er ist der vielleicht spannendste Entrepreneur unserer Zeit: Elon Musk, Macher von PayPal, Tesla, SpaceX. Hier die Geschichte seiner ersten Gründung, Zip2, die er 1994 zusammen mit seinem Bruder startete. Im Gepäck hatte der damals 23-Jährige eine vage Idee über die Chancen, die ein Dotcom-Unternehmen bieten könnte, 2000 US-Dollar Kapital, ein Auto und einen Computer.

Sommer 1994: Elon und sein Bruder Kimbal machten den ersten Schritt auf ihrem Weg, waschechte Amerikaner zu werden (aufgewachsen waren sie in Südafrika): Sie unternahmen eine Autoreise durch das ganze Land. Kimbal hatte als Franchise-Nehmer für College Pro Painters im Grunde ein eigenes kleines Unternehmen geführt und damit gut verdient. Er verkaufte seine Lizenz und legte die Einnahmen mit dem zusammen, was Elon zur Hand hatte, um einen alten, angeschlagenen BMW 320i zu kaufen.

Die Brüder begannen ihre Reise im August in der Nähe von San Francisco, als es in Kalifornien richtig heiß wurde. Der erste Teil ihrer Fahrt führte sie nach Needles, einer Stadt in der Mojave-Wüste. Dort erlebten sie das schweißtreibende Abenteuer von 49 Grad in einem Auto ohne Klimaanlage und gewöhnten sich an, ihre Pausen bei der Burgerkette Carl’s Jr. einzulegen, wo sie sich stundenlang zum Abkühlen aufhielten. Die Reise bot reichlich Gelegenheiten für den typischen Quatsch von jungen Männern in ihren Zwanzigern und wilde kapitalistische Tagträume.

Dank Verzeichnisdiensten wie Yahoo! und Software wie dem Net-scape-Browser hatte das Web gerade begonnen, massentauglich zu werden. Die Brüder waren begeistert vom Internet und dachten darüber nach, zusammen ein Web-Unternehmen zu gründen. Von Kalifornien bis Colorado wechselten sie zwischen Fahren, Brainstorming und Unsinnreden, bevor sie wieder Richtung Osten fuhren, um Elon rechtzeitig zum Semesterbeginn im Herbst zurück zur Universität zu bringen. Die beste Idee, die aus dieser Reise hervorging, war ein Online-Netzwerk für Ärzte. Es war nicht so ambitioniert wie die elektronischen Patientenakten von heute, sondern eher ein System für den Austausch von Informationen und Zusammenarbeit. „Die Medizinbranche sah aus wie eine, in der es eine Disruption geben könnte. Später machte ich mich daran, einen Businessplan und die Strategie für Vertrieb und Marketing auszuarbeiten, aber es wurde nichts daraus. "Wir haben die Idee nicht geliebt“, sagt Kimbal.

Den Anfang des Sommers hatte Elon mit zwei Praktika im Silicon Valley verbracht. Tagsüber arbeitete er im Pinnacle Research Institute in Los Gatos, einem viel gelobten Start-up, in dem ein Team von Wissenschaftlern nach Möglichkeiten suchte, Superkondensatoren als revolutionäre Energiequelle für Elektro- und Hybridautos einzusetzen. Zumindest in Ansätzen neigte die dortige Arbeit auch zum Bizarren. Elon konnte ausgiebig darüber sprechen, wie Superkondensatoren in der Tradition von Star Wars und so ziemlich jedem anderen futuristischen Film für Laserwaffen eingesetzt werden könnten. Die Laser sollten enorme Mengen Energie abfeuern, anschließend sollte der Schütze den Superkondensator wechseln wie bei konventionellen Waffen das Magazin – und schon konnte es weitergehen.

Auch als Stromversorgung für Raketen sahen Superkondensatoren vielversprechend aus. Sie waren weniger anfällig für die mechanischen Belastungen beim Start als Batterien und besser darin, Strom über längere Zeiträume zu speichern. Elon verliebte sich in die Arbeit bei Pinnacle und begann, das Unternehmen als Basis für seine Experimente mit Business-Plänen an der Universität und seine Fantasien als Industrieller zu nutzen. Abends dann machte er sich auf dem Weg zu Rocket Science Games, einem Start-up in Palo Alto, das die fortschrittlichsten Videospiele herstellen wollte, die es je gegeben hatte; dazu sollten die Spiele nicht mehr auf Kassetten gespeichert werden, sondern auf CDs mit ihrer viel höheren Kapazität. Theoretisch war es dadurch möglich, Spielen so aufwendige Geschichten und eine so hohe Qualität wie Hollywood-Filmen zu geben, und an dieser Arbeit war ein gemischtes Team aus angehenden Stars ihres Fachs – teils Ingenieure, teils Filmmenschen – beteiligt. Tony Fadell, der später entscheidend zur Entwicklung von iPod und iPhone bei Apple beitragen sollte, arbeitete ebenso bei Rocket Science wie das Team, das für Apple die Multimedia-Software QuickTime entwickelt hatte. Ebenfalls dabei waren Leute, die bei Industrial Light & Magic für die Effekte von Star Wars verantwortlich waren, und einige, die zuvor bei LucasArts Entertainment Spiele entwickelt hatten. Rocket Science gab Elon ein Gefühl dafür, was das Silicon Valley hinsichtlich Kultur und Talenten zu bieten hatte.

Manche Mitarbeiter waren rund um die Uhr in ihren Büros und niemand fand es das kleinste bisschen merkwürdig, dass Elon immer erst um 17 Uhr zu seinem Zweitpraktikum erschien. „Wir hatten ihn geholt, damit er einen maschinennahen Programmcode schreibt“, sagt Peter Barrett, ein australischer Ingenieur, der das Unternehmen mit auf den Weg gebracht hatte. „Er war absolut unerschütterlich. Ich glaube, schon nach kurzer Zeit gab ihm niemand mehr irgendwelche Anweisungen. Und am Ende machte er, was er wollte.“ Konkret sollte Musk die Treiber schreiben, mit deren Hilfe Joysticks und Mäuse mit unterschiedlichen Computern und Spielen kommunizieren. Treiber sind die nervigen kleinen Dateien, die Sie auch zu Hause installieren müssen, wenn Sie einen Drucker oder eine Kamera mit Ihrem PC verbinden wollen – eine langweilige Angelegenheit.

Elon hatte sich das Programmieren selbst beigebracht. Er fand sich recht gut darin, also gab er sich anspruchsvollere Aufgaben. „Im Prinzip überlegte ich mir Möglichkeiten für Multitasking, wie man also Videos von einer CD einlesen und gleichzeitig das Spiel laufen lassen kann“, erklärt Musk. „Damals war immer nur eines von beidem möglich. Um das zu ändern, brauchte es ein bisschen komplizierte Assembler-Programmierung.“ Kompliziert ist genau das richtige Wort. Elon musste Befehle programmieren, die sich direkt an den Hauptprozessor von Computern richten und in grundlegendste Funktionen dieser Maschinen eingreifen. Bruce Leak, der frühere leitende Techniker für QuickTime bei Apple, hatte das Praktikum von Elon genehmigt und war angetan von dessen Fähigkeit, nächtelang durchzuarbeiten. „Er hatte endlos viel Energie. Die jungen Leute von heute haben keine Ahnung mehr von Hardware oder davon, wie etwas funktioniert, aber er war ein echter PC-Hacker und hatte keine Angst davor, einfach loszulegen und Sachen herauszufinden“, sagt Leak.

Im Silicon Valley fand Elon reichlich Gelegenheiten, wie er sie suchte, und einen Ort, der zu seinen Ambitionen passte. Die folgenden zwei Sommer über kehrte er dorthin zurück, und nach seinen zwei Abschlüssen in Pennsylvania zog er ganz an die Westküste. Anfangs wollte er noch einen Doktor in Materialwissenschaft und Physik an der Stanford University machen und die Arbeit an Superkondensatoren, die er bei Pinnacle begonnen hatte, fortsetzen. Doch wie es so gehen kann – schon nach zwei Tagen hörte er in Stanford wieder auf, weil er den Ruf des Internets unwiderstehlich fand. Er überredete Kimbal, ebenfalls ins Silicon Valley zu kommen, um zusammen mit ihm das Web zu erobern. Auf die ersten Ideen für ein lukratives Internetunternehmen war Elon während seiner Praktika gestoßen. Einmal kam ein Vertreter der Gelben Seiten ins Büro eines der Start-ups und versuchte, ihm als Ergänzung zu der üblichen Auflistung im dicken Branchenbuch einen Online-Eintrag zu verkaufen. Der Vertreter tat sich schwer bei seinen Bemühungen und wusste offensichtlich wenig darüber, was das Internet eigentlich war oder wie man ein Unternehmen darin finden könnte. Das schwache Verkaufsgespräch brachte Elon ins Grübeln und er kontaktierte Kimbal, um mit ihm über eine neue Idee zu sprechen: Unternehmen dabei helfen, eine Präsenz im Internet zu erhalten. „,Diese Leute wissen nicht, wovon sie sprechen. Vielleicht wäre das was für uns‘, sagte Elon zu mir“, berichtet Kimbal. Das war im Jahr 1995 und bald gründeten die Brüder Global Link Information Network, ein Start-up, das sie später in Zip2 umbenannten.

Die Idee für Zip2 war genial. Im Jahr 1995 verstanden nur wenige kleine Unternehmen die Bedeutung des Internets. Sie wussten wenig darüber, wie sie im Netz präsent sein konnten, und sahen keinen großen Wert darin, eine eigene Website aufzubauen oder sich in Online-Branchenbüchern zu präsentieren. Elon und sein Bruder wollten Restaurants, Kleidungsläden, Friseure und ähnliche Geschäfte davon überzeugen, dass die Zeit reif für sie war, die im Web surfende Öffentlichkeit auf sich aufmerksam zu machen. Zip2 sollte ein durchsuchbares Verzeichnis von Unternehmen aufbauen und es in Karten einbinden. Musk erklärte das Konzept häufig mithilfe von Pizza: Jeder habe das Recht, den Standort der am nächsten gelegenen Pizzeria und eine genaue Wegbeschreibung dorthin zu bekommen. Heute mag das offensichtlich erscheinen – es ist eine Mischung aus Yelp und Google Maps. Damals aber hatten noch nicht einmal hartgesottene Kiffer einen solchen Dienst erträumt.

Die Adresse von Zip2 war 430 Sherman Avenue in Palo Alto. Die Musk-Brüder mieteten ein Einraumbüro von 6 mal 9 Metern Größe und kauften ein paar einfache Möbel dafür. Das dreistöckige Gebäude hatte seine Besonderheiten. Es gab keinen Aufzug und die Toiletten waren häufig verstopft. „Es war ganz wörtlich ein Scheißplatz zum Arbeiten“, sagt einer der frühen Angestellten. Für eine schnelle Internetverbindung machte Elon einen Deal mit Ray Girouard, einem Entrepreneur, der im Stockwerk unter Zip2 einen Internetprovider betrieb. Laut Girouard bohrte Elon in der Nähe der Eingangstür von Zip2 ein Loch in die Gipskartondecke, durch das er dann ein Ethernet-Kabel zu dem Provider verlegte. „Ein paar Mal haben sie zu spät bezahlt, aber sie haben mich nie um mein Geld betrogen“, sagt Girouard.

Die gesamte erste Programmierung für den Dienst erledigte Elon selbst, während der umgänglichere Kimbal sich um den Aufbau des Tür-zu-Tür-Vertriebs kümmerte. Elon hatte eine billige Lizenz für eine Datenbank mit Namen und Adressen von Unternehmen in der Bay Area gekauft. Als Nächstes wandte er sich an Navteq, ein Unternehmen, das Hunderte Millionen Dollar für die Erstellung von digitalen Karten und Wegbeschreibungen für frühe GPS-Navigationsgeräte ausgegeben hatte. Das Ergebnis war sehr erfreulich: „Wir riefen dort an und sie gaben uns die Technologie umsonst“, erzählt Kimbal. Elon führte die beiden Datenbanken zusammen und brachte so ein rudimentäres System zum Laufen. Mit der Zeit ergänzten Zip2-Programmierer diesen ersten Datenbestand dann um weitere Karten für Gebiete außerhalb der großen Metropolregionen. Außerdem entwickelten sie eigene Wegbeschreibungen, die gut aussehen und gut auf normalen Heimcomputern angezeigt werden sollten.

Errol Musk gab seinen Söhnen als Unterstützung für die Startphase 28.000 Dollar, doch nachdem sie das Büro, Softwarelizenzen und etwas Technik bezahlt hatten, waren sie mehr oder weniger pleite. Die ersten drei Monate des Bestehens von Zip2 lebten die Brüder in ihrem Büro. Sie hatten einen kleinen Schrank, in dem sie ihre Kleidung aufbewahrten, zum Duschen gingen sie in eine Jugendherberge. „Manchmal aßen wir viermal am Tag bei Jack In The Box“, sagt Kimbal. „Dort war 24 Stunden geöffnet, was gut zu unserem Arbeitsstil passte. Einmal holte ich mir einen Smoothie und es war irgendetwas darin. Ich nahm es einfach heraus und trank weiter. Seit dieser Zeit kann ich nicht mehr dort essen, aber ich kenne immer noch die Speisekarte auswendig.“ Als Nächstes mieteten die Brüder ein Appartement mit zwei Schlafzimmern – für Möbel fehlte ihnen sowohl das Geld als auch das Interesse, also gab es nur ein paar Matratzen auf dem Boden.

Irgendwie überredete Elon einen jungen südkoreanischen Programmierer, im Tausch gegen Kost und Logis als Praktikant bei Zip2 anzufangen. „Der arme Junge dachte, er bekäme einen Job in einem großen Unternehmen“, erzählt Kimbal. „Stattdessen wohnte er bei uns und hatte keine Ahnung, worauf er sich einließ.“ Eines Tages wollte der Praktikant mit dem angeschlagenen BMW 320i zur Arbeit fahren, als ihm ein Rad absprang. An der Kreuzung Page Mill Road und El Camino Real bohrte sich die Achse in den Boden. Die von ihr gezogene Rille war noch Jahre später dort zu sehen.Zip2 mag ein voll im Trend liegendes Internetunternehmen für das Informationszeitalter gewesen sein, doch um es ins Laufen zu bringen, brauchte es ganz altmodisches Klinkenputzen für den Vertrieb. Unternehmen mussten von den Vorzügen des Web überzeugt und mit Charme dazu gebracht werden, für etwas Unbekanntes zu bezahlen.

Ende 1995 stellten die Musk-Brüder ihre ersten Mitarbeiter ein und bauten ein kunterbuntes Vertriebsteam auf. Einer der ersten Angestellten war Jeff Heilman, ein freigeistiger 20-Jähriger, der noch nicht recht wusste, was er mit seinem Leben anfangen sollte. Eines Abends hatte er zusammen mit seinem Vater im Fernsehen einen Werbespot gesehen, bei dem unten auf dem Bildschirm eine Webadresse eingeblendet wurde. „Er war für irgendwas.com“, erinnert sich Heilman. „Ich weiß noch, wie ich dort saß und meinen Vater fragte, was das sein sollte. Der sagte, er wisse es auch nicht. Da wurde mir klar, dass ich losgehen musste, um etwas über das Internet zu erfahren.“ Ein paar Wochen lang versuchte Heilman, Leute zu finden, die ihm das Internet erklären konnten. Dann sah er eine kleine Stellenanzeige von Zip2 in der Zeitung San Jose Mercury News. „Internetverkäufer hier bewerben!“, hieß es darin und Heilman bekam den Job.

Elon schien das Büro nie zu verlassen. Einem Hund nicht unähnlich, schlief er auf einem Knautschsack neben seinem Schreibtisch. „Ich kam fast jeden Tag um 7.30 oder 8 Uhr ins Büro und dann sah ich ihn dort auf dem Sack schlafen“, sagt Heilman. „Geduscht hat er vielleicht am Wochenende. Ich weiß es nicht.“ Elon bat die ersten Zip2-Mitarbeiter, ihn kurz zu treten, wenn sie kamen; dann wachte er auf und fing wieder an zu arbeiten. Während Elon obsessiv programmierte, wurde Kimbal der mitreißende Vertriebschef. „Kimbal war der ewige Optimist und sehr, sehr motivierend. Ich hatte noch nie jemanden wie ihn getroffen“, sagt Heilman. Kimbal schickte ihn in das schicke Stanford-Einkaufszentrum und in die University Avenue, die wichtigste Attraktion von Palo Alto, um die dortigen Geschäftsinhaber zu einem Vertrag mit Zip2 zu überreden – ein bezahlter Eintrag, so erklärte Heilman immer wieder, garantiere dem Unternehmen eine Auflistung an der Spitze der Suchergebnisse.

Das Problem dabei war natürlich, dass niemand anbiss. Woche für Woche klopfte Heilman an Türen und kam zurück ins Büro, ohne viel Gutes berichten zu können. Noch am nettesten waren die Antworten von Leuten, die sagten, Werbung im Internet sei das Blödeste, von dem sie je gehört hätten. Meistens aber sagten die Inhaber Heilman nur, er solle verschwinden und sie in Ruhe lassen. Immer gegen Mittag griffen die Musks in die Zigarrenkiste, in der sie etwas Geld aufbewahrten, luden Heilman zum Essen ein und ließen sich den deprimierenden Statusbericht über seine Verkaufsbemühungen geben. Craig Mohr, ein weiterer früher Mitarbeiter, gab seinen Job als Immobilienverkäufer auf, um die Dienste von Zip2 anzubieten. Er entschied sich, sein Glück bei Autohändlern zu versuchen, weil die normalerweise viel Geld für Werbung ausgeben. Er erzählte ihnen von der Hauptwebsite von Zip2 – www.totalinfo.com – und versuchte sie davon zu überzeugen, es gebe starke Nachfrage nach Einträgen.

Der Dienst funktionierte nicht immer, wenn Mohr ihn vorführen wollte, oder die Seiten wurden, wie es damals üblich war, sehr langsam geladen. Dadurch war er gezwungen, die Kunden vor allem mit warmen Worten vom Potenzial von Zip2 zu überzeugen. „Einmal kam ich mit ungefähr 900 Dollar in Schecks zurück“, erzählt er. „Ich ging ins Büro und fragte die Jungs, was ich mit dem Geld machen soll. Elon hörte auf, auf seine Tastatur zu hämmern, schaute hinter seinem Monitor hervor und sagte: ,Du hast Geld – das kann doch nicht sein!‘“ Was den Optimismus der Mitarbeiter am Leben erhielt, waren die ständigen Verbesserungen von Elon an der Zip2-Software. Von einer reinen Konzeptstudie hatte er den Dienst zu einem echten Produkt entwickelt, das tatsächlich genutzt und vorgeführt werden konnte. Als geschickten Marketingtrick versuchten die Musk-Brüder, ihren Webdienst bedeutender aussehen zu lassen, indem sie ihm eine imposante physische Erscheinung gaben. Elon baute ein riesiges Gehäuse um einen normalen PC und montierte ihn auf ein Gestell mit Rädern.

Wenn dann mögliche Investoren vorbeikamen, machte Elon eine Show daraus, diese scheinbar riesige Maschine hereinzurollen. Damit erweckte er den Eindruck, Zip2 laufe auf einem Mini-Supercomputer. „Die Investoren fanden das beeindruckend“, sagt Kimbal. Heilman fiel außerdem auf, dass sie die sklavische Ergebenheit von Elon für das Unternehmen schätzten. „Schon damals, als er im Prinzip noch ein College-Junge mit Pickeln war, hatte Elon diesen Antrieb, dass diese Sache – was immer sie war – gemacht werden musste und dass er, wenn er sie nicht machen würde, den Anschluss verpassen würde“, sagt er. „Ich glaube, das haben die Wagniskapitalgeber erkannt – dass er bereit war, seine Existenz auf den Aufbau dieser Plattform zu verwetten.“ Ziemlich genau so äußerte sich Musk gegenüber einem Kapitalgeber auch selbst: „Ich habe eine Mentalität wie ein Samurai. Ich würde eher Selbstmord begehen als zu scheitern.“

So ging es weiter mit Zip2

1999 kaufte der damalige Hardware-Riese Compaq das Start-up Zip2 für 307 Millionen Dollar. Dies war der größte Betrag, der bis dahin jemals für ein Internetunternehmen gezahlt worden war. Die Beteiligung von Elon war immerhin 22 Millionen Dollar wert.

Der Beitrag ist ein Auszug aus der nun auch auf Deutsch erschienenen Biografie „Der wahre Iron Man“. Ashlee Vance, der US-Wirtschaftsjournalist und Autor der Biografie, hat für sein Buch mehr als 40 Stunden persönlich mit Elon Musk verbracht und exklusiven Zugang zu seinem familiären Umfeld erhalten. Erzählt wird Musks kometenhafter Aufstieg von seiner Flucht aus Südafrika mit 17 Jahren bis heute. Entstanden ist die inspirierende und spannende Geschichte eines der erfolgreichsten Querdenker.

Ashlee Vance, Elon Musk, Wie Elon Musk die Welt verändert - Die Biografie, ISBN: 978-3-89879-906-5, Finanzbuch Verlag 2015, 19,99 EUR

Purpose statt Profit-Exit: Kann das Food-Start-up pack&satt den Massenmarkt knacken?

Das 2021 von Sophie Gnest und Liss Barta gegründete Food-Start-up pack&satt setzt bewusst auf Verantwortungseigentum. Gelingt jetzt der Sprung in den hart umkämpften Massenmarkt?

Fertiggerichte haben traditionell ein oft kritisches Image, doch der Markt für Convenience Food wächst seit Jahren kontinuierlich. Die Gründerinnen Sophie Gnest und Liss Barta positionieren sich in diesem lukrativen, aber hart umkämpften Segment mit ihrem Start-up pack&satt als nährstoffreiche und nachhaltige Alternative. Dass dieser Ansatz massives Marktpotenzial hat, bewies zuletzt die BIOFACH in Nürnberg: Dort zeichnete eine Jury aus Vertreter*innen des Handels pack&satt als Start-up des Jahres 2026 aus. Doch der Weg aus der Nische in die Skalierung birgt massive vertriebliche Herausforderungen.

Vom MVP zum Pivot: Customer Feedback als Treiber

Die Entstehungsgeschichte von pack&satt, die ins Jahr 2021 zurückreicht, liest sich wie ein klassischer Lean-Start-up-Prozess. Auf der Suche nach veganen Alternativen für die schnelle Küche begann Gründerin Sophie Gnest zunächst, eigene Instant-Rezepte zu entwickeln. Der erste sogenannte einpott startete im Pfandglas – ein klassisches Minimum Viable Product (MVP). Über eine erste Crowdfunding-Kampagne auf Startnext, die von über 500 Menschen unterstützt wurde, finanzierte das Start-up die erste Produktion.

Statt auf diesem ersten Wurf zu verharren, nutzte das Team das Feedback der ersten Kundengeneration für einen entscheidenden Pivot. Für den „einpott 2.0“ wurde die Rezeptur angepasst, der Proteingehalt erhöht und – logistisch besonders relevant – das schwere Pfandglas durch eine vollständig recycelbare Papierverpackung ersetzt. Die Auszeichnung auf der Fachmesse belegt nun, dass diese strategische Weiterentwicklung im Branchenumfeld deutlich wahrgenommen wird.

Go-to-Market: Der harte Kampf um das Supermarktregal

Das aktuelle Kernprodukt bietet in drei verschiedenen Sorten ein Mittagessen, das lediglich mit heißem Wasser aufgegossen wird und fünf Minuten ziehen muss. Dabei fokussiert sich pack&satt auf proteinreiche Mahlzeiten aus verständlichen, natürlichen Rohstoffen. Damit positioniert sich das Start-up als klarer Gegenentwurf zum branchenweiten Trend der hochverarbeiteten Lebensmittel (Ultra-Processed Foods). Zudem gehört das Unternehmen mit seinem Fertiggericht zu den Vorreitern bei papierbasierten Verpackungen in diesem Segment.

Der Gewinn des Start-up Awards dient nun als starker Proof of Concept (PoC) und könnte dem Unternehmen den Zugang zum stationären Handel erleichtern. Doch hier wartet die eigentliche Bewährungsprobe: Der Markt für schnelle Mahlzeiten ist stark umkämpft. Um den Schritt von der Nische in den Massenmarkt erfolgreich zu vollziehen, muss das Team im B2B-Vertrieb nun Hürden wie Listungsgebühren, Margendruck und den harten Verdrängungswettbewerb im Einzelhandel meistern.

Deep Dive für Gründer*innen: Verantwortungseigentum – Hype oder Zukunftsmodell?

Aus Investor*innensicht besonders spannend ist die rechtliche Aufstellung: Pack&satt wurde im Verantwortungseigentum gegründet. Für die klassische Start-up-Szene bedeutet das ein klares Anti-Establishment-Signal. Das Unternehmen ist unverkäuflich, ein klassischer Exit an Konzerne ist somit ausgeschlossen. Erwirtschaftete Gewinne verbleiben im Unternehmen und sollen in die Förderung von Nachhaltigkeit oder andere gemeinnützige Zwecke fließen.

Doch was bedeutet das strategisch für andere Gründungsteams? Die Stiftung Verantwortungseigentum definiert das Modell über zwei unumstößliche Prinzipien: die absolute Selbstbestimmung (die Kontrolle bleibt immer bei den aktiven Unternehmern, nicht bei anonymen Investoren) und die strenge Vermögensbindung (Asset-Lock).

- Für wen ist das Modell geeignet?

Verantwortungseigentum ist ideal für wertegetriebene "Purpose"-Gründer*innen, die ihre Mission rechtlich vor einer feindlichen Übernahme, Heuschrecken oder dem kurzfristigen Renditedruck des Kapitalmarkts absichern wollen. Es garantiert Unabhängigkeit über Generationen hinweg und ist ein massiver Hebel im Employer Branding, um Top-Talente zu binden, die nach echtem Sinn in ihrer Arbeit suchen.

- Für wen ist es NICHT geeignet?

Für klassische Venture-Capital-Cases ist dieses Setup ein Dealbreaker. Wer für schnelles, hyperaggressives Wachstum auf klassisches Eigenkapital von VC-Fonds angewiesen ist oder als Gründer*in den eigenen, lukrativen Exit als persönliches Finanzziel definiert hat, wird mit diesem Modell scheitern. Da Investor*innen hier keine Rendite durch einen Unternehmensverkauf erzielen können, scheiden sie als klassische Geldgeber*innen aus. Zudem ist die juristische Umsetzung (etwa über Doppelstiftungs- oder Veto-Share-Modelle) aktuell oft noch teuer und komplex, solange eine dezidierte neue Rechtsform für dieses Konstrukt in Deutschland fehlt.

Während ein Großteil der Food-Start-ups also auf Venture Capital schielt, um sich Marktanteile teuer zu erkaufen, wählt pack&satt bewusst den Weg zwischen Purpose und Profitdruck. Dieses Modell wirft die spannende geschäftliche Frage auf, wie das Start-up die kapitalintensive Skalierung im stationären Handel ohne klassisches Eigenkapital finanzieren wird.

Pack&satt steht damit beispielhaft für eine Reihe neuer Start-ups, die gesellschaftliche Werte stark in ihre Unternehmensstruktur einbinden. Nach dem Erfolg beim Fachpublikum auf der BIOFACH zielt das Team nun darauf ab, einem breiteren Konsument*innenkreis zugänglich zu werden. Ob die Etablierung in den Supermarktregalen dauerhaft gelingt, wird maßgeblich davon abhängen, wie agil sich das Start-up im wettbewerbsintensiven Einzelhandel behaupten kann.

1 Mio. Euro ARR ohne Investor*innen: Der kalkulierte Drahtseilakt von Inno KI

Eine Million Euro ARR in zwei Jahren – ganz ohne Investor*innen. Wie das Start-up Inno KI den VC-Hype ignoriert und sein B2B-Geschäft nutzt, um mutige B2C-Testballons zu finanzieren.

Das KI-Start-up Inno KI aus dem niedersächsischen Vechta vermeldet einen Meilenstein: Im Mai 2026 – rund zwei Jahre nach der Gründung – hat das Unternehmen die Marke von einer Million Euro Annual Recurring Revenue (ARR) erreicht. Das Besondere daran: Dieser Aufbau gelang vollständig aus eigenem Startkapital und ohne externes Wachstumskapital. In einem Markt, der primär von milliardenschweren Risikokapitalrunden Schlagzeilen macht, horcht die Szene auf. Ein genauerer Blick auf das Geschäftsmodell zeigt jedoch: Die Unabhängigkeit hat ihren Preis – und ermöglicht zugleich überraschende strategische Freiheiten.

Vom Agentur-Projekt zur DSGVO-Plattform

Die Historie von Inno KI zeigt einen klassischen pragmatischen Ansatz. Das Unternehmen entstand unter anderem aus der Marketing-Agentur moin media und der Magic Labs GmbH, die bereits ab 2022 intensiv mit KI-Anwendungen experimentierten. Aus der Kernfrage, wie Mitarbeiter rechtssicher und datenschutzkonform mit Künstlicher Intelligenz arbeiten können, wurde Ende 2024 schließlich die Plattform innoGPT gelauncht.

Hinter dem Projekt stehen die Gründer Mike Koene und Maurice Brumund, der als Geschäftsführer agiert. Das von ihnen entwickelte Produkt fungiert als Brücke zu den großen Sprach- und Bildgenerierungsmodellen der US-Konzerne und europäischer Entwickler*innen – darunter OpenAI, Anthropic, Google, Meta und Mistral sowie Black Forest Labs. Der entscheidende Hebel für den deutschen Mittelstand: Die Plattform ist komplett DSGVO-konform und wird auf Servern in Deutschland innerhalb der EU gehostet. Laut Unternehmensangaben nutzen bereits über 1.000 Unternehmen und mehr als 600 Professionals das System täglich, unterstützt von einem Netzwerk aus über 30 Vertriebspartnern. Zu den namhaften Kund*innen zählen Schwergewichte wie PwC, die GC Gruppe, Hansa-Flex und die Böckmann Fahrzeugwerke.

Die ARR-Metrik im Branchen-Check

Innerhalb der Start-up-Welt ist die Kennzahl ARR (Annual Recurring Revenue) ein hoch bewertetes Gut, da sie in der Regel für planbare und hochskalierbare Abo-Einnahmen steht. Inno KI erklärt in seiner Mitteilung, dass die Plattform derzeit mit rund 30 Prozent pro Monat wächst. Gleichzeitig fließen Einnahmen aus begleitendem KI-Consulting und intensiven Schulungen direkt in die Weiterentwicklung des Produkts.

Für Analyst*innen zeigt sich hier ein interessanter Hybrid: Während klassische SaaS-Investoren oft eine strikte Trennung von reinen Software-Lizenzen und schwer skalierbaren Dienstleistungen fordern, nutzt Inno KI eine starke Verknüpfung beider Welten. Consulting und das vom Unternehmen angebotene Change-Management sind zeit- und personalintensiv. Das aktuelle Wachstum wird somit maßgeblich durch ein Systemhaus-ähnliches Modell querfinanziert. Das senkt zwar das finanzielle Risiko enorm, wirft bei Tech-Puristen aber unweigerlich die Frage auf, wie schnell sich das Modell global ohne massiven Personaleinsatz skalieren lässt.

Technologische Tiefe vs. „Middleware“-Dilemma

Technologisch bewegt sich innoGPT im Bereich der Middleware. Das Start-up entwickelt keine eigenen Foundation-Modelle, sondern legt eine datenschutzkonforme Schnittstellen-Hülle über bestehende Drittanbieter-Technologien. In der Tech-Szene wird bei solchen Modellen oft die Tiefe des technologischen „Burggrabens“ hinterfragt.

Den oft geäußerten Vorwurf, ein reiner „API-Wrapper“ zu sein, kontert Inno KI jedoch mit einer eigenen technologischen Wertschöpfungsschicht: Wie StartingUp bereits in der Meldung zum B2C-Vorstoß von innoGPT berichtete, nutzt das System eine "Named Entity Recognition". Dabei werden sensible personenbezogene Daten in hochgeladenen Dokumenten automatisch durch Platzhalter ersetzt, bevor sie überhaupt an die Schnittstellen der US-Anbieter*innen gesendet werden.

Zusätzlich zu diesem technischen Datenschutz bleibt die Strategie stark auf die menschliche Komponente fokussiert: Da die Einführung von KI primär die Veränderung von Arbeitsweisen bedeutet, ist das operative Change-Management ein fester Bestandteil der Leistung geworden. Die Kund*innenbindung erfolgt also maßgeblich durch Beratungs- und Implementierungskompetenz vor Ort.

B2B als Cashcow für den B2C-Testballon

Geschäftsführer Maurice Brumund betont, dass man Angebote von Kapitalgeber*innen bewusst abgelehnt habe. Der Verzicht auf Venture Capital sichere dem Unternehmen die Unabhängigkeit von harten Quartalsvorgaben externer Investoren, die fast immer einen schnellen Exit anstreben. Für Kund*innen wolle man so ein stabilerer, langfristiger Partner sein.

Genau diese Unabhängigkeit erklärt auch die ungewöhnlichen strategischen Züge des Start-ups. Die Gewinne aus dem B2B-Kerngeschäft dienen als Motor für neuartige Experimente. Wie wir kürzlich berichteten, wagt sich Inno KI mit einem „Family Package“ (34,90 Euro/Monat) an den ungelösten datenschutzkonformen KI-Zugang für Familien und das Kinderzimmer heran. Ein derartiger B2C-Testballon für ein B2B-fokussiertes Unternehmen wäre unter dem strengen Fokus klassischer VC-Geber*innen, die meist eine eindimensionale Skalierung im Kerngeschäft fordern, kaum denkbar gewesen.

Fazit

Inno KI liefert ein starkes Beispiel für erfolgreiches Bootstrapping im deutschen Tech-Sektor. Dem Team ist es gelungen, die akute Compliance-Unsicherheit des Mittelstands schnell und profitabel zu monetarisieren. Der Fall zeigt Gründer*innen, dass ein tragfähiges Geschäftsmodell im KI-Bereich nicht zwingend auf Milliardeninvestitionen basieren muss, wenn die vertriebliche Nische und der Service stimmen. Ob sich das Hybrid-Modell langfristig gegen die fortschreitende Marktkonsolidierung der Tech-Riesen behauptet, wird sich zeigen – doch vorerst nutzt Inno KI seine finanzielle Freiheit konsequent für eigene Wege.

paXos Solar: Das Kraftwerk-Dach

Sieben Jahre Entwicklung, ein renommierter Design-Preis und ein ambitioniertes Crowdinvesting: Wie das Start-up paXos Solar der Gründer Karsten Birkholz und Guido Schumacher den umkämpften Markt für gebäudeintegrierte Photovoltaik (BIPV) aufmischen will – und warum das Nadelöhr im Handwerk liegt.

Das Langenfelder GreenTech-Start-up paXos Solar hat mit seinem „Multi-Energie-Dach“ den Green Product Award 2026 in der Kategorie Building Design gewonnen. Das Konzept verspricht, das Dach vom bloßen Witterungsschutz zum integrierten Kraftwerk für Strom und Wärme zu transformieren. Für das Hardware-Start-up markiert dieser renommierte Preis einen Meilenstein auf dem Weg zur nächsten Finanzierungsrunde. Dennoch zeigt ein tieferer Blick auf das Geschäftsmodell, die tiefen Wurzeln des Teams im Engineering und die hochkomplexe Wettbewerbslandschaft, dass der Markt für gebäudeintegrierte Photovoltaik (BIPV) weit mehr verlangt als gutes Design.

Die Auszeichnung als Momentum

Ende Mai 2026 wurde im Berliner Colosseum der Green Product Award verliehen. Unter 1.200 Einreichungen aus 54 Ländern setzte sich das Multi-Energie-Dach von paXos durch. Die Jury lobte insbesondere den ganzheitlichen Ansatz, der Aspekte wie Verarbeitung, Lebenszyklus, Langlebigkeit und die Kreislauffähigkeit der Materialien berücksichtigt. Für paXos kommt die Auszeichnung genau zur rechten Zeit, da das Start-up in rund einem Monat eine Skalierungsrunde über die Crowdinvesting-Plattform FunderNation starten will.

Warum man sich in einer solch kapitalintensiven Hardware-Phase für die Crowd und gegen klassisches Venture Capital (VC) entschieden hat? „Wir sehen Crowdinvesting nicht als Ersatz für professionelle Investoren, sondern als sehr passenden Baustein für unsere aktuelle Skalierungsphase“, erklärt CFO Guido Schumacher. Über die Plattform könne man Kapital aufnehmen, ohne die Gesellschafterstruktur zu früh und zu stark zu verwässern.

Zudem gehe es um Reichweite und Community-Aufbau. Schumacher betont: „Unser Produkt lebt von Vertrauen, Sichtbarkeit und Weiterempfehlung. Eine Crowdinvesting-Kampagne bringt uns mit Menschen zusammen, die die Energiewende im Gebäudesektor aktiv unterstützen, selbst bauen oder im Handwerk tätig sind.“

„Klassisches VC-Geld schließen wir für spätere, größere Skalierungsschritte nicht aus“, räumt er ein. Doch zunächst liege der Fokus auf dem aktuellen Ausbau. „Für den nächsten Marktausbau planen wir ein Finanzierungsziel von bis zu 1,5 Millionen Euro“, kündigt der CFO an. „Damit wollen wir insbesondere Material und Projekte vorfinanzieren sowie unser Vertriebs- und Verarbeitungspartnernetzwerk ausbauen.“

Die Wurzeln im Engineering: Ein Corporate Spin-off mit langem Atem

Hinter paXos Solar steckt kein klassisches Hochschul-Spin-off in den frühen Zwanzigern. Das Kernteam um CEO Karsten Birkholz und CFO Guido Schumacher verbindet eine über 30-jährige gemeinsame berufliche Vorgeschichte, stark verwurzelt in der Automobilindustrie und dem klassischen Engineering. Zusammen mit Erfinder Peter Hakenberg bauten sie ab 2015 zunächst das erfolgreiche Ingenieurbüro paXos Consulting & Engineering auf.

Bereits im Jahr 2017 sorgte die Truppe auf der Hannover Messe für Schlagzeilen, als erste Prototypen in den Medien voreilig als deutsche Antwort auf das Tesla Solar Roof gehandelt wurden. Guido Schumacher relativiert diesen frühen Hype heute: „Der Tesla-Vergleich war damals natürlich aufmerksamkeitsstark, aber 2017 standen wir nicht kurz vor einem fertigen Marktstart.“

Bis das hardwareintensive Produkt vollends marktreif war, vergingen fast sieben Jahre. Erst Ende 2024 startete das Unternehmen voll in den operativen Betrieb. „Ein Solardach ist kein klassisches Tech-Produkt, das man nach einem funktionierenden Demonstrator einfach skaliert“, gibt Schumacher zu bedenken. „Es muss über Jahrzehnte dicht, sicher, belastbar und wirtschaftlich funktionieren – und es muss auf der Baustelle von Dachdeckern verarbeitet werden können.“

Dass paXos diese enorm lange und risikoreiche Vorlaufzeit überstand, lag auch an der eigenen Entstehungsgeschichte. „Ein wesentlicher Teil der frühen Entwicklung konnte über paXos Consulting & Engineering querfinanziert werden“, verrät der CFO. Die wahre Hürde sei eine andere gewesen: „Die größte Herausforderung lag weniger in der Technik als im mentalen Wechsel“, blickt er zurück. „Als Ingenieurdienstleister denkt man in individuellen Kundenprojekten. Als Produktunternehmen muss man in Standards, Wiederholbarkeit, Lieferketten und Marge denken.“

Technologie und Lieferkette: Das Doppelkraftwerk auf dem Prüfstand

Das Kernprodukt von paXos ersetzt konventionelle Dachziegel vollständig. Auf einem soliden Unterdach aus gewöhnlichem Stahltrapezblech werden werkzeuglos Solarmodule eingehängt. Der technologische Clou: Ein Kamineffekt zwischen Blech und Modul sorgt für eine kontinuierliche Hinterlüftung, was einen leistungsmindernden Hitzestau verhindert. Die warme Luft wird zudem abgesaugt und einer Wärmepumpe zugeführt, was deren Energiebedarf laut Unternehmensangaben um bis zu 20 Prozent senken kann.

Auf die kritische Frage nach der Resilienz der globalen Lieferketten antwortet CEO Karsten Birkholz entwaffnend ehrlich: „Unsere Glas-Glas-Solarmodule werden aktuell in Asien nach unseren Spezifikationen gefertigt.“ Er verteidigt diesen Schritt selbstbewusst: „Dort finden wir derzeit die beste Kombination aus hoher Fertigungsqualität, technologisch führender Zelltechnologie und wirtschaftlicher Skalierbarkeit.“

Dennoch versichert Birkholz, sich nicht von Standard-Importen abhängig zu machen. „Wir kaufen keine Standardmodule von der Stange. Die paXos-Qualität entsteht durch unser spezifisches Moduldesign und die Integration in unser Dachsystem“, betont der CEO. Die eigentliche Wertschöpfung des Start-ups liege in der Systemintegration und der Logik des Dachaufbaus.

Der Markt und seine kritischen Hürden

Obwohl der Markt für energetische Dachsanierungen gigantisch ist, muss sich paXos in einem dicht besiedelten Umfeld gegen Anbieter wie Autarq, Ennogie oder traditionelle Ziegelhersteller behaupten. Die größte Skalierungshürde liegt jedoch oft nicht in der Technologie, sondern in der Schnittstelle zum traditionellen Handwerk. Ein Indach-System verwischt häufig die Grenzen zwischen dem/der Dachdecker*in und dem/der Elektriker*in – was in der Praxis regelmäßig zu Gewährleistungsängsten führt.

PaXos begegnet diesem Flaschenhals mit einer strikten konzeptionellen Trennung. „Unser wichtigstes Argument ist: Es bleibt im Kern ein Dachsystem“, stellt Karsten Birkholz klar. „Wir trennen die Funktionen bewusst: Das Unterdach übernimmt die Wasserführung und den Wetterschutz, die PV-Ziegel bilden die energieerzeugende Ebene darüber.“ Das reduziere die Sorgen der Handwerker*innen massiv.

Zudem punkte man mit hoher Reparaturfreundlichkeit, verspricht der CEO: „Bei uns können einzelne Module vergleichsweise einfach ausgetauscht werden, ohne das gesamte Dach öffnen zu müssen. Das ist für Dachdecker ein starkes Argument, weil es die langfristige Verantwortung beherrschbarer macht.“ Sein Fazit zum Schnittstellen-Problem ist entsprechend deutlich: „Wir verwischen die Gewerke nicht, sondern strukturieren sie sauber. Der Dachdecker verantwortet den Dachaufbau und die Montage, der Elektriker verantwortet Verschaltung und Inbetriebnahme.“

Einordnung für die StartingUp-Community

Für Gründer*innen und Investor*innen im GreenTech-Sektor liefert paXos Solar eine wertvolle Fallstudie. Der Case untermauert, dass physische Hardware im CleanTech-Bereich zwar langwierig ist, aber das unverzichtbare Rückgrat der realen Energiewende bildet.

Darüber hinaus bedient die intelligente Verschmelzung der klassischen Gebäudehülle mit moderner Stromerzeugung und thermischer Unterstützung exakt das ganzheitliche Denken, das heute von modernen ESG-Investor*innen gefordert wird. Der anstehende Schritt hin zum Crowdinvesting ist dabei ein strategisch kluger Schachzug, um bei einem emotional aufladbaren Produkt Kleininvestor*innen direkt zu Markenbotschafter*innen zu machen. Ob das erfahrene Team nach den Design-Jurys nun auch das traditionelle deutsche Bauhandwerk in der Breite überzeugen kann, wird sich in der anstehenden Wachstumsphase zeigen müssen.

Vom Planungs-Tool zum Kraftwerks-Betreiber: Furo greift im Milliardenmarkt für Industriespeicher an

Das Software-Unternehmen Furo, ehemals Lumera Energy, bringt eine neuartige Lösung für gewerbliche Batteriespeicher auf den Markt. Das große Versprechen des Münchner Gründungsteams: eine deutlich schnellere Amortisation der Anlagen durch KI-gestützte Multi-Use-Optimierung. Doch wie realistisch sind diese ambitionierten Ziele in einem hochkomplexen und streng regulierten Marktumfeld?

Gegründet wurde Furo im Jahr 2025 von Lena Sophia Voß, Leonie Wagner und Simon Wittner. Das Trio bringt Praxiserfahrung aus dem Silicon Valley mit – geprägt durch Stationen bei Apple, Google X und der Boston Consulting Group sowie akademischen Abschlüssen der Stanford University und der UC Berkeley.

Auf die Frage, warum man mit einer solchen Vita ausgerechnet im oft zähen Deutschland gründet und nicht in den USA bleibt, kontert Mitgründerin Lena Sophia Voß die landläufige Skepsis selbstbewusst. „Oft hört man, man solle in Deutschland gar nicht gründen. Dem würden wir so nicht zustimmen“, betont Voß. Sie verweist auf das extrem gründungsaffine Münchner Netzwerk und Förderungen wie das exist-Gründungsstipendium, welches die Startphase des Unternehmens maßgeblich mitfinanziert hat.

Dennoch räumt die Gründerin strukturelle Hürden ein: „Was jedoch stimmt: In Deutschland geht vieles noch langsamer. Unternehmen zu gründen, Finanzierungsrunden abzuschließen – all das dauert hier länger.“ Auch die Mentalität unterscheide sich stark: „Kulturell wird man hierzulande immer noch gefragt, warum man so viel Risiko auf sich nimmt, anstatt einem sicheren Job nachzugehen. Unsere amerikanischen Freunde haben da ganz anders reagiert.“

Planung und Echtzeitbetrieb aus einer Hand

Nachdem sich das junge Start-up in der DACH-Region und Spanien bereits erfolgreich als Standard-Tool für die Simulation gewerblicher Speicher etabliert hat, folgt nun der nächste strategische Schritt: Mit dem neuen Software-Launch übernimmt die Plattform künftig nach der Planung auch nahtlos den Echtzeitbetrieb, die Optimierung und die Vermarktung der Anlagen.

Das System basiert auf einer „virtuellen Batterie“. Dieser digitale Zwilling soll bereits vor der Installation die zu erwartenden Einnahmen exakt berechnen. Sobald die Anlage am Netz ist, übernehmen KI-gestützte Prognosen, aktiver Energiehandel und eine kontinuierliche Multi-Use-Optimierung die Steuerung. Furo stellt Industriebetrieben in Aussicht, ihr wirtschaftliches Potenzial um bis zu 40 Prozent zu steigern und die Amortisationszeit von branchenüblichen 15 auf sportliche fünf Jahre zu verkürzen.

Doch wie beweist man konservativen Industriekunden solche traumhaften Laborwerte im realen Betrieb? Voß setzt hier auf radikale Transparenz: „Bevor ein Kunde auch nur einen Cent investiert, starten wir mit einer Potenzialanalyse auf Basis historischer Verbrauchsdaten. Erst dann kommt unsere virtuelle Batterie ins Spiel.“

Der eigentliche Clou liege in der Technologie selbst: „Dieses Prognosemodell ist dasselbe, das später auch den echten Betrieb steuert – jede Projektion ist damit direkt an der Realität messbar“, verspricht die Gründerin. Während traditionelle Systeme nach statischen Regeln agieren, nutze Furo eine vorausschauende KI, die auf Basis von Echtzeitpreisen und Wetterdaten berechnet, wie der Speicher am Folgetag am wirtschaftlichsten eingesetzt wird. Voß bringt es auf den Punkt: „Was wir garantieren: Kein Kunde geht ohne eine belastbare, datenbasierte Kalkulation in eine Investitionsentscheidung.“

Start-up vs. Energie-Goliaths: Ein unterversorgtes Marktsegment

Während etablierte Betreiber*innen virtueller Kraftwerke sich vorrangig auf lukrative Großspeicher ab 10 Megawatt konzentrieren, bleibt das gewerblich-industrielle Segment oft unterversorgt. Furo besetzt genau diese Nische für Anlagen im Bereich von rund 150 Kilowatt bis hin zu über 3 Megawatt.

Dass etablierte Energiemarkt-Riesen Furo diesen Platz einfach streitig machen könnten, glaubt Voß nicht. Gewerbliche Speicher müssten gleichzeitig Eigenverbrauch maximieren, Lastspitzen kappen, Netzentgelte optimieren und am Energiemarkt teilnehmen. „Diese Kombination aus mehreren Anwendungsfällen in einem einzigen System – das ist die eigentliche Komplexität, die große Energieversorger und Aggregatoren nicht abbilden können“, analysiert sie messerscharf. Deren Systeme seien auf reine Marktarbitrage ausgelegt, nicht auf die betriebliche Realität einer Fabrik.

Auch Batteriehersteller*innen seien keine direkte Konkurrenz, da sie unter enormem asiatischen Hardwaredruck stünden und kaum Kapazitäten für eigene Softwareentwicklung hätten. Player wie Enpal, die Deutsche Bahn, sonnen, Fenecon oder BayWa arbeiten laut Furo bereits mit dem Start-up zusammen. Wer heute noch in dieses Segment wolle, müsse bei null anfangen. „Mit jeder neuen Partnerschaft werden wir jeden Tag schneller. Das kann niemand einfach replizieren“, untermauert Voß den Burggraben ihres Unternehmens.

Was passiert, wenn sich der Markt beruhigt?

Die Versprechen klingen verlockend, bedürfen jedoch einer kritischen Betrachtung. Die anvisierte fünfjährige Amortisationszeit hängt naturgemäß stark an dauerhaft hohen Preisschwankungen am Strommarkt. Sollte sich diese Volatilität durch den Netzausbau künftig stabilisieren, könnten die Margen im Energiehandel empfindlich schrumpfen. Zudem erfordert die internationale Skalierung in teils stark regulierte Netze einen massiven Entwicklungsaufwand.

Auf das Risiko schrumpfender Margen angesprochen, verweist Voß auf ein robustes Erlösmodell. „Unser Umsatzmodell ist bewusst dreigleisig aufgebaut: eine SaaS-Lizenz für die Planungsplattform, eine Betriebslizenz für das Betriebssystem und ein Erfolgsanteil an Handelserträgen“, erklärt sie. Die Lizenzeinnahmen seien von kurzfristigen Preissprüngen völlig unabhängig. Zudem funktioniere die Wertschöpfung durch lokale Optimierungen beim Kund*innen – wie Lastspitzenkappung – auch in einem stabilen Preisumfeld weiterhin wirtschaftlich.

Unser Fazit

Furo liefert ein Paradebeispiel für einen klugen strategischen Ansatz: Aus einem reinen Einstiegsprodukt zur Anlagenplanung wird sukzessive ein umfassendes Ökosystem. Mit dem initialen Tool hat das Team Vertrauen bei mittlerweile rund 100 zahlenden Kund*innen und über 600 Nutzer*innen aufgebaut. Der nun vollzogene Schritt zum aktiven Anlagenbetreiber ist logisch, verlagert das Geschäftsrisiko jedoch stark in Richtung der technischen Ausführung.

Für die kommenden zwölf Monate steht laut Voß vor allem der vollständige Rollout der Plattform im Fokus. „Wir übernehmen die intelligente Steuerung der Speicher in Echtzeit und optimieren sie täglich neu.“

Die größte Herausforderung bleibt allerdings die Politik und die träge Infrastruktur. Die laufende Reform der Netzentgelte betrachtet Voß noch als Chance für agile Software-Anbieter. Viel mehr Kopfzerbrechen bereitet der Gründerin hingegen die Hardware-Realität: „Das strukturelle Problem bleibt der Netzanschluss: Zu viele Projekte warten zu lange, bis sie überhaupt ans Netz dürfen. Das bremst nicht nur uns – das bremst die gesamte Energiewende.“

Wenn das Team mehr verdient als der Chef

Im Interview mit MCANISM-Gründer und -CEO Gunnar Militz haken wir kritisch nach: Ist das niedrige Gründergehalt clevere PR, schlichte Notwendigkeit oder ein echtes Führungs-Tool? Und wie behauptet sich ein Nischen-Player technologisch gegen die bequemen Standard-Tools der großen Tech-Giganten?

Das Klischee vom gut verdienenden Geschäftsführer hält sich hartnäckig. Doch in der Praxis wachsender mittelständischer Unternehmen zeigt sich oft ein anderes Bild. Gunnar Militz, Gründer und Geschäftsführer der 2018 in Hamburg gegründeten MCANISM Technology GmbH, positioniert sich hierbei bewusst als Gegenentwurf: Nach Angaben des Unternehmens zahlt er sich ein Fixgehalt von unter 100.000 Euro aus, womit Teile seines Teams mehr verdienen als er selbst. Im Gründungsjahr verzichtete er demnach sogar komplett auf ein Einkommen.

Dieses Prinzip der finanziellen Risikobereitschaft soll sich auch im Geschäftsmodell spiegeln: Das Performance-Marketing-Netzwerk setzt auf eine proprietäre Tracking-Technologie ohne Drittanbieter und fokussiert sich auf Nischen wie die Lebensmittel- und Reisebranche.

In diesem Interview haken wir kritisch nach: Ist das niedrige Gründergehalt clevere PR, schlichte Notwendigkeit oder ein echtes Führungs-Tool? Und wie behauptet sich ein Nischen-Player technologisch gegen die bequemen Standard-Tools der großen Tech-Giganten?

Das Interview

StartingUp: Herr Militz, laut eigener Angaben verdienen Sie bewusst deutlich unter 100.000 Euro im Jahr, während Teile Ihres Teams mehr nach Hause bringen. Kritisch gefragt: Wie viel davon ist clevere Employer-Branding-PR und wie viel schlichte finanzielle Notwendigkeit für das Wachstum von MCANISM? Bitte nennen Sie uns den konkreten strategischen Hebel, den diese Gehaltsstruktur für Ihr Unternehmen hat.

Gunnar Militz: Es ist weder reine PR noch blanke Not aus der Kasse. Der strategische Hebel ist die Kapitaleffizienz. Als Unternehmer muss man verstehen: Jeder Euro, den ich mir privat auszahle, ist nach Steuern und Sozialabgaben nur noch die Hälfte (oder sogar weniger) wert. Wenn dieser Euro aber in der Firma bleibt, ist er „brutto“ und arbeitet für das Wachstum. Die Rendite, die ich erziele, wenn ich das Kapital in unsere eigene Technologie oder in den Marktausbau stecke, ist faktisch immer höher als das, was ich privat am Kapitalmarkt damit erreichen könnte. Wir lassen das Cash im Unternehmen, damit es dort mit Hebel arbeiten kann. Das ist kein Verzicht, sondern Reinvestition in den eigenen Erfolg.

StartingUp: Im Gründungsjahr 2018 gab es für Sie gar kein Gehalt, nur die Krankenversicherung war abgedeckt. Solche Phasen werden von Gründer*innen im Nachhinein gern als heldenhafte „Hustle“-Phase romantisiert. Wie sah die Realität aus – gab es einen konkreten Moment, in dem Sie diese Entscheidung bereut haben, und wie hat diese Zeit die Fehlerkultur in Ihrem Unternehmen geprägt?

Gunnar Militz: Bereut habe ich es nie, aber es lehrt einen Demut gegenüber der Cashflow-Planung. Man lernt, den "Lifestyle-Fokus" komplett gegen den "Impact-Fokus" zu tauschen. Ich hatte keine Zeit zum Geldausgeben! Was viele unterschätzen: Ein niedriges Fixgehalt bedeutet ja nicht, dass man am Hungertuch nagt, wenn man die steuerlichen Spielräume nutzt. Wer clever ist, nutzt Werkzeuge wie die 0,25%-Regelung für E-Autos oder rechnet Geschäftsreisen korrekt ab. Das reduziert die privaten Lebenshaltungskosten legal und effizient.

Diese Zeit hat unsere Fehlerkultur massiv geprägt: Wenn es dein eigenes Geld ist, das du verbrennst, entwickelst du einen sechsten Sinn für Effizienz. Wir probieren viel aus, aber wir stoppen Dinge radikal, die keinen ROI bringen. Diese „Skin in the Game“-Mentalität verlange ich heute auch von der Struktur, nicht nur von mir selbst. Aber Vorsicht: Man muss dabei extrem sauber arbeiten. Gerade wenn man mehr als 25% der Anteile hält, schaut das Finanzamt beim Fremdvergleich ganz genau hin. Die Bezüge müssen angemessen sein – weder darf man sich künstlich arm rechnen, um Steuern zu sparen, noch darf man die Firma als Selbstbedienungsladen nutzen. Diese steuerliche Disziplin ist das Fundament für unsere Unabhängigkeit.

StartingUp: Wenn Angestellte am Monatsende mehr verdienen als der Chef, kann das klassische Hierarchien ins Wanken bringen. Wie wirkt sich diese Struktur in der täglichen Praxis tatsächlich auf Ihre natürliche Autorität aus? Bitte geben Sie uns ein konkretes Beispiel, wie Sie mit Gehaltsverhandlungen von Top-Talenten umgehen, deren Forderungen Ihr eigenes Gehalt sprengen.

Gunnar Militz: In der Praxis merke ich davon weniger als man denkt. Autorität kommt nicht davon, dass man das höchste Gehalt im Raum hat. Das war vielleicht mal so, aber in unserem Umfeld zählt eher wer klar entscheidet und wer Verantwortung übernimmt. Wenn ich als Geschäftsführer sichtbar nicht das Maximum für mich raushole, schafft das eher Glaubwürdigkeit als Schwäche. Bei konkreten Gehaltsverhandlungen ist mein eigenes Gehalt schlicht kein Referenzpunkt. Wenn jemand für eine kritische Rolle gebraucht wird, vergüten wir marktgerecht oder drüber. Was die Rolle kostet, hängt vom Impact ab und nicht davon, was ich verdiene. Dafür muss ich mich dann auch nicht rechtfertigen.

StartingUp: Ihre eigene Vergütung ist stark an Tantiemen gekoppelt, Sie gehen also voll ins persönliche Risiko. MCANISM setzt parallel auf eine proprietäre Softwarelösung ohne Drittanbieter. Wie hängt diese „Skin in the Game“-Mentalität mit der Entscheidung zusammen, sich technologisch unabhängig zu machen, anstatt kostensparend auf bestehende Standard-Tools zurückzugreifen?

Gunnar Militz: Das hängt direkt zusammen. Wer variabel vergütet ist, denkt automatisch in längeren Zeiträumen. nicht nur beim Umsatz, sondern auch bei Abhängigkeiten. Standard-Tools sind bequemer und kurzfristig günstiger, aber wir haben uns bewusst dagegen entschieden. Das bedeutet mehr Aufwand und mehr Risiko, doch dafür kontrollieren wir unsere Daten, unsere Logik und letztlich unser Geschäftsmodell. Das ist wie auch beim Gehalt dieselbe Grundhaltung: lieber mehr Risiko tragen, aber nicht abhängig sein.

StartingUp: Eine eigene Tracking-Technologie zu betreiben, ist teuer. Viele Kund*innen sind zudem an die Dashboards von Google oder Meta gewöhnt. Mit welchen handfesten Argumenten – abseits des oft bemühten Themas Datenschutz – bringen Sie Marketingabteilungen dazu, ihre Gewohnheiten aufzugeben und auf Ihre unabhängige Lösung zu wechseln?

Gunnar Militz: Das entscheidende Argument ist nicht das Tool, sondern die Frage, wer hier eigentlich für wen optimiert. Google und Meta bauen ihre Dashboards nach ihren Interessen und weniger nach denen ihrer Kunden. Wir argumentieren konkret: Attribution, Provisionsmodelle, Kampagnenlogiken – das alles lässt sich mit uns deutlich individueller steuern. Für Unternehmen, die ihre Kanäle wirklich verstehen wollen und nur auf Plattform-KPIs schauen, macht das einen messbaren Unterschied. Der Wechsel ist kein Selbstläufer, weil Gewohnheiten sitzen, das ist klar. Aber sobald jemand einmal sieht, wie eine unabhängige Sicht auf Performance aussieht, ist die Bereitschaft deutlich höher.

StartingUp: Mit den Netzwerken Chefs Campaign und Hotel Campaign fokussieren Sie sich auffällig spitz auf die Lebensmittel- und Reisebranche. Andere Affiliate-Netzwerke agieren deutlich breiter. Verstecken Sie sich in der Nische vor dem großen Wettbewerb oder worin genau liegt der messbare Leistungs- und ROI-Vorteil für Partner wie HelloFresh oder NH Hotels? Bitte nennen Sie uns hierfür einen konkreten Faktor, den Generalisten nicht abdecken können.

Gunnar Militz: Wir verstecken uns nicht, wir entscheiden uns. Food und Travel haben sehr spezifische Anforderungen: andere Customer Journeys, andere Buchungslogiken, andere Conversion-Mechaniken. Ein Generalist bildet das irgendwie ab. Wir bilden es genau ab. Der konkrete Unterschied liegt darin, wie wir Provisionsmodelle und Conversion-Prozesse modellieren. Näher am tatsächlichen Geschäftsmodell unserer Partner, nicht an einem generischen Template. Für HelloFresh oder NH Hotels bedeutet das weniger Streuverlust und bessere Steuerbarkeit. Das ist messbar.

StartingUp: Lassen Sie uns einen „Realitätscheck“ in Sachen Wahrnehmung von Gründer*innen-Gehältern machen. Welchen ungeschönten, praxisnahen Rat geben Sie einem jungen Gründungs-Team, das heute seinen ersten Businessplan schreibt und entscheiden muss, wie hoch das eigene Fixgehalt ausfallen darf, ohne das Unternehmen oder sich selbst zu ruinieren?

Gunnar Militz: Das eigene Gehalt ist kein Belohnungssystem. Das ist der Kern. Zu hoch, und das Unternehmen hat ein Problem. Zu niedrig, und man selbst hat irgendwann ein Problem – und zwar eines, das sich in Entscheidungen niederschlägt, ob man will oder nicht. Ich rate dazu, sich zwei ehrliche Fragen zu stellen: Was brauche ich wirklich, um vernünftig arbeiten zu können? Und was kann die Firma in dieser Phase tragen? Dazu früh über variable Modelle nachdenken. Und war nicht als Sparmaßnahme, sondern weil es die eigenen Interessen mit dem Unternehmenserfolg verbindet. Und dann noch etwas, das unterschätzt wird: Was am Anfang richtig ist, muss in zwei Jahren nicht mehr stimmen. Die eigene Rolle verändert sich. Das sollte man nicht erst merken, wenn es zu spät ist.

Gunnar Militz, Danke für die spannenden Insights!

Das Interview führte StartingUp-Chefredakteur Hans Luthardt

KI-Werkstattmeister: Revolutioniert Kai Karosse die KFZ-Schadensanalyse?

Handyfoto statt Werkstatt-Odyssee: Das Berliner Start-up Kai Karosse verspricht präzise Reparatur-Kostenschätzungen per KI. Ein radikaler Ansatz, der die Branche herausfordert – doch der digitale Blick durch die Smartphone-Kamera hat physikalische Grenzen.

Der Schreckmoment ist fast jedem/jeder Autofahrer*in bekannt: Einmal beim Ausparken unaufmerksam gewesen, und schon prangt eine hässliche Delle im Kotflügel. Was folgt, ist meist eine zeitraubende Odyssee durch Werkstätten, um Kostenvoranschläge zu vergleichen. Das 2025 in Berlin gegründete Start-up Kai Karosse will diesen Prozess nun radikal verkürzen. Die Gründer David Schmeußer und Rico-Thore Kauert verfolgen eine klare Vision: Die Bewertung eines Karosserieschadens soll künftig so einfach funktionieren wie ein Online-Einkauf.

Die 3.000-Euro-Delle und das Versprechen der Transparenz

Die Idee zum Unternehmen entsprang laut David Schmeußer klassischem Alltagsfrust. Vor einer Leasingrückgabe fuhr der Gründer wegen zwei kleiner Dellen in der Tür bei drei verschiedenen Werkstätten vor. „Die Angebote variierten damals zwischen 300 und 3.000 Euro“, erinnert er sich. „Ich fragte mich: Wie kann das sein? Warum ist dieser Markt so intransparent? Warum muss ich als Kunde überall vorstellig werden?“

Den entscheidenden Anstoß gab schließlich seine Frau mit der Frage, warum man nicht einfach eine künstliche Intelligenz nach einem realistischen Preis frage. Eine Marktrecherche ergab zudem, dass jährlich rund eine Million Suchanfragen allein zu Smart Repair und verwandten Themen gestellt werden. Die Lösung der Berliner: Ein virtueller Werkstattmeister, der Kostenschätzungen binnen 30 Sekunden erstellt.

Aus redaktioneller Sicht klingt das nach einer perfekten Lösung für genervte Verbraucher. Allerdings rühren eklatante Preisunterschiede in der Praxis nicht nur von mangelnder Transparenz her, sondern oft von völlig unterschiedlichen Reparaturwegen: Wo die eine Werkstatt spachtelt und beilackiert (Smart Repair), kalkuliert die markengebundene Vertragswerkstatt den strikten Austausch der kompletten Tür nach Herstellervorgaben. Eine KI muss also nicht nur den Schaden erkennen, sondern auch den gewählten Reparaturweg transparent machen.

Domänen-Intelligenz vs. schmutziger Lack

Wie verhindert man, dass der Algorithmus eine teure Erneuerung empfiehlt, wo eine Politur gereicht hätte? Kai Karosse setzt auf eine Analyse-Pipeline, in der das Sprachmodell nur ein Baustein ist. Da Fotos keinen natürlichen Maßstab besitzen, nutzt die KI „Skalenanker“ wie Türgriffe oder Münzen, um die exakte Größe des Schadens zu berechnen.

Doch das Risiko von KI-Halluzinationen – etwa durch Schmutz, Regentropfen oder Spiegelungen im Metalliclack – ist hoch. „Wir nutzen verschiedene Verfahren, um Halluzinationen bestmöglich auszuschließen“, erklärt Schmeußer und nennt sogenannte Confidence-Werte als Instrument. „Wir fragen die KI also: ‚Wie sicher bist du, dass deine Analyse stimmt?‘“ Ist sich der Algorithmus unsicher, wird seine Aussage geringer gewichtet. Zudem muss die KI ihre Entscheidungsfaktoren textlich ausgeben und wird aufgefordert, sich quasi selbst zu überprüfen. „Das ist so, als stelle man die Frage: ‚Bist du ganz sicher? Bitte durchlaufe den Prozess erneut und prüfe, ob dein Ergebnis wirklich valide ist‘“, so der Gründer.

Das Start-up macht hier vieles richtig, indem es dem Algorithmus misstraut. Dennoch: Eine KI, die sich selbst prüft, operiert letztlich nur innerhalb ihrer eigenen Systemgrenzen. Ist das Ausgangsmaterial – das Foto des Kunden bzw. der Kundin – schlecht, nützt auch die beste Selbstprüfung wenig. Das weiß auch Schmeußer und räumt ein, dass der „Faktor Mensch“ oft das größte Hindernis sei. Werden nur verschwommene Nahaufnahmen hochgeladen, fehlen Kontext und Bauteil-Zuordnung.

Der harte Realitätscheck in der Werkstatt

Unter der Haube gleicht das System den Schaden mit einer Eignungsmatrix ab und empfiehlt Smart Repair, konventionelle Reparatur oder Austausch. Die Preise kalibriert das System dabei anhand der Daten einer bundesweit tätigen Werkstattkette mit über 550 Filialen. Hier liegt ein kritischer Flaschenhals des Geschäftsmodells: Die Datenbasis einer einzelnen – wenn auch großen – Kette reicht kaum aus, um das hochkomplexe, regional schwankende Preisgefüge des gesamten deutschen Reparaturmarktes abzubilden.

In der Werkstatt-Zunft regt sich entsprechend Widerstand. „Ja, den gab und gibt es, und er ist sicherlich auch teilweise berechtigt“, gibt sich Schmeußer selbstkritisch. Karosseriebauer warnen vehement davor, dass scheinbare Bagatellschäden oft strukturelle Probleme wie gebrochene Halterungen oder sicherheitsrelevante Airbag-Schäden verbergen. Auch die Preisspannen bei Originalteilen seien für die KI „noch schwer zu berücksichtigen“, gibt der Gründer zu.

Man übermittle bei jeder Schätzung daher transparent die zugrunde liegenden KI-Annahmen. „Ähnlich wie ein erfahrener menschlicher Gutachter wird Kai Karosse solche Risiken mit der Zeit immer besser einschätzen können, je mehr Daten zur Verfügung stehen“, argumentiert Schmeußer. Das System solle künftig lernen, dass etwa bei einer tiefen Delle am Stoßfänger oft auch die Aufhängung beschädigt ist.

Trotz dieser Lernkurve bleibt ein strukturelles Problem bestehen: Wenn die KI vorab 500 Euro prognostiziert, der Meister auf der Hebebühne aber verborgene Schäden für weitere 1.000 Euro entdeckt, droht massiver Kund*innenfrust. Die KI weckt Erwartungen, die die Werkstatt am Ende vielleicht nicht halten kann. Schmeußer sieht das naturgemäß positiver: „Die Hebebühne bleibt natürlich die letzte Instanz, doch der Kunde hat bereits vorab einen Wissensvorsprung. Das ist ein entscheidender Unterschied.“

David gegen die Software-Goliath

Der Markt ist ein Haifischbecken, dominiert von Konzernen wie der Allianz und etablierten Branchenstandards wie Audatex oder DAT, die über jahrzehntelange Datenhistorien verfügen. Wie will ein gebootstrapptes Start-up hier bestehen?

Man wolle Fahrzeugbesitzer*innen einen Weg völlig losgelöst von Versicherungsvorgaben oder Werkstattbindungen bieten, kontert Schmeußer. Gleichzeitig positioniert sich Kai Karosse als B2B-Lösung: „Wir möchten unsere Anwendung Werkstätten zur Verfügung stellen, die ihren Kunden eine einfache und zeitgemäße Lösung anbieten wollen.“

Der Prozess solle radikal vereinfacht werden: „Bild hochladen, Angebot erhalten, Termin buchen, Vorfahren und Schaden beheben lassen. Fertig!“, skizziert Schmeußer seine Idealvorstellung. „Davon ist die Branche derzeit weit entfernt.“

Fazit: Geniales Lead-Tool oder echtes Gutachten?

Das Potenzial für die Software ist unbestritten vorhanden, insbesondere als Lead-Generierung für Werkstätten oder zur groben Vorfilterung im Flottenmanagement. Auf die Frage nach der Entwicklung in den nächsten drei Jahren gibt sich Schmeußer bodenständig: „Wäre Kai Karosse in drei Jahren die erste Anlaufstelle für die Behebung von Karosserieschäden und das Mittel der Wahl für Werkstattwebsites und Flottenanbieter, wäre das ein sehr großer Erfolg.“

Ob dieser Erfolg eintritt, hängt von einer zentralen Frage ab: Kann die Software das Erwartungsmanagement der Nutzer*innen kontrollieren? Kai Karosse liefert aktuell kein belastbares Gutachten, sondern eine smarte Erstindikation. Schafft es das Unternehmen, diese technologische Grenze gegenüber den Autofahrer*innen transparent zu kommunizieren, könnte die Berliner KI tatsächlich viel Frust aus dem Schadensprozess nehmen. Verlässt sich der/die Kund*in aber blind auf die 30-Sekunden-Rechnung des Algorithmus, folgt die Ernüchterung auf dem Fuß – spätestens an der Hebebühne.

Stallgrün: Mit Hightech-Kräutern gegen den Agrar-Strukturwandel

Leere Ställe als Chance: das 2023 von Judith Ryll und Thorsten Lansmann-Niehaus gegründete Stallgrün nutzt Bestandsbau für Indoor Farming. Wir checken das Modell hinter der aktuellen 125.000-€-DBU-Förderung.

Der Strukturwandel in der deutschen Landwirtschaft ist unaufhaltsam: Allein zwischen 2013 und 2023 ging die Zahl der hiesigen Betriebe mit Schweinehaltung um 44 Prozent zurück, wie Zahlen des Bundesministeriums für Ernährung und Landwirtschaft (BMEL) belegen. Jedes Jahr geben Landwirt*innen auf. Zurück bleiben leere Ställe – und Landwirtschaftsbetriebe auf der Suche nach neuen finanziellen Perspektiven.

Das 2023 in Münster gegründete Start-up Stallgrün will aus diesen „Stranded Assets“ einen lukrativen Zukunftsmarkt formen: Indoor Farming im ehemaligen Schweinestall. Die Deutsche Bundesstiftung Umwelt (DBU) unterstützt das Projekt aktuell mit 125.000 Euro im Rahmen ihrer Green Startup-Förderung. Wir wollten wissen: Wie tragfähig ist das Modell jenseits der Fördergelder wirklich?

Die Köpfe hinter der Idee & die Historie

Hinter Stallgrün stehen die Gründer Judith Ryll und Thorsten Lansmann-Niehaus. Ryll bringt als Biowissenschaftlerin tiefe Expertise in der Pflanzenbiologie mit, während Lansmann-Niehaus – der bezeichnenderweise selbst auf einem Schweinemastbetrieb aufwuchs – die kaufmännische Führung übernimmt. Gefördert durch regionale Inkubatoren wie das Seedhouse, hat das Duo den technologischen Machbarkeitsnachweis bereits erbracht: In den vergangenen zwei Jahren wurde das Konzept auf einer Pilotfarm erfolgreich entwickelt.

Das Geschäftsmodell: Mehr als nur Hardware

Die Grundprämisse ist so simpel wie pragmatisch: Ehemalige Schweineställe sind in der Regel massiv gebaut sowie gut isoliert und bieten damit architektonisch ideale Bedingungen für den ganzjährigen Anbau von regionalen Kräutern und Gemüse. Stallgrün positioniert sich als B2B-Technologie- und Service-Provider für Höfe im Wandel und will deutschlandweit agieren. Das System fußt auf drei wesentlichen Säulen:

- Automatisierte Anlagentechnik: Als Kernprodukt hat das Start-up während der DBU-Förderung eine Anlage entwickelt, welche die Bewässerung, Düngung, Belichtung und Klimatisierung automatisiert steuert.

- Datengetriebene Agrar-Software: Ergänzend liefert das Team spezifische Anbauprotokolle für die teilnehmenden Betriebe. Für geeignete Kulturen wurde der optimale Einsatz von Parametern wie Saatgut, Erde, Dünger, Licht und Bewässerungszyklen definiert.

- B2B-Ökosystem: Um die Einstiegshürde zu minimieren, hat Stallgrün einen Materialhandel für passendes Anbaumaterial aus einer Hand aufgebaut und bietet rechtliche Hilfen bei der Verwaltung an. Zudem unterstützt das Start-up beim Aufbau der Vermarktung.

Stallgrün versteht sich dabei nicht als Feind der traditionellen Landwirtschaft. Laut Lansmann-Niehaus ist Indoor Farming kein Ersatz für den etablierten Freiland- oder Gewächshausanbau, sondern eine wetter- und klimaunabhängige Ergänzung.

Die Vision: Produkte sollen ganzjährig regional verfügbar gemacht werden. Die vermehrte Nutzung regionaler Lebensmittel anstelle von Importen reduziere zudem den Transportaufwand und die daraus entstehenden Emissionen.

Kritische Markteinordnung

Der Markt für Vertical- und Indoor-Farming ist ein hartes Pflaster. Prominente Branchenvorreiter wie das ehemals hochgelobte Berliner Start-up Infarm haben in der Vergangenheit massiv Risikokapital verbrannt, weil die schiere Skalierung von energieintensiven Hightech-Farmen in urbanen Ballungsräumen betriebswirtschaftlich oft zum Scheitern verurteilt war.

Hier liegt der geniale, aber auch kritische Hebel von Stallgrün: Anstatt teure Gewerbeimmobilien anzumieten, nutzt das Team bestehende, ländliche Infrastruktur. Das verhindert eine zusätzliche Versiegelung von Flächen, was auch DBU-Generalsekretär Alexander Bonde als zentralen ökologischen Faktor hervorhebt. Ein weiterer Wettbewerbsvorteil: Viele Höfe verfügen bereits über großflächige Photovoltaikanlagen auf ihren Stalldächern. Damit lässt sich der enorme Strombedarf für die Belichtung und Klimatisierung teilweise direkt durch eigenen, günstigen Sonnenstrom abdecken.

Dennoch bleiben aus unserer Sicht drei gravierende Hürden für das Geschäftsmodell:

- CAPEX-Intensität: Die Umrüstung eines leeren Stalls in eine funktionsfähige Hightech-Anlage ist extrem kapitalintensiv. Es bleibt fraglich, wie Landwirte, die gerade aus der unprofitablen Schweinehaltung ausgestiegen sind, das nötige Investitionskapital für diesen Hardware-Neustart bei ihren Banken abrufen können.

- Radikaler Kulturwandel: Einen traditionellen Schweinemäster in einen agilen, datengetriebenen Indoor-Kräuterproduzenten zu transformieren, erfordert enormen Beratungs- und Change-Management-Aufwand seitens Stallgrün.

- Wettbewerb & Margendruck: Die teilnehmenden Bauern und Bäuerinnen kämpfen letztlich gegen die extrem knappen Margen des Lebensmitteleinzelhandels.

Unser Fazit

Stallgrün liefert einen erfrischend bodenständigen „Hardware-meets-Agrar“-Ansatz in einem Tech-Segment, das lange Zeit von utopischen, rein urbanen Vertical-Farming-Träumereien dominiert wurde. Durch die kluge Umnutzung von Infrastruktur-Altlasten und die clevere Kombination aus Hardware, Software-Protokollen und einem integrierten B2B-Serviceangebot hat das Duo ein System aufgebaut, das ein hohes Skalierungspotenzial besitzt.

Die DBU-Förderung von 125.000 Euro ist ein sauberes Validierungssignal für den positiven ökologischen Impact der Gründer*innen. Die wahre Reifeprüfung wird nun jedoch in den Bilanzen der kooperierenden Landwirte stattfinden: Nur wenn die Höfe durch den automatisierten Anbau zügig ihre hohen Anfangsinvestitionen amortisieren können, wird aus dem Münsteraner Pilotprojekt ein neuer bundesweiter Agrar-Standard. Ein mutiger Pivot für die heimische Landwirtschaft – und ein Start-up, das man als Investor*in und Beobachter*in der Agrar-Wende unbedingt auf dem Zettel haben sollte.

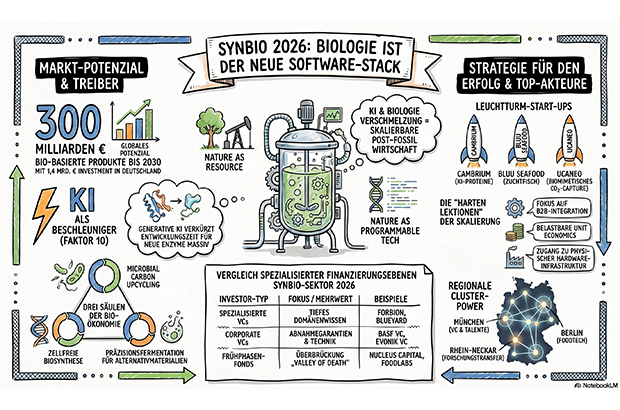

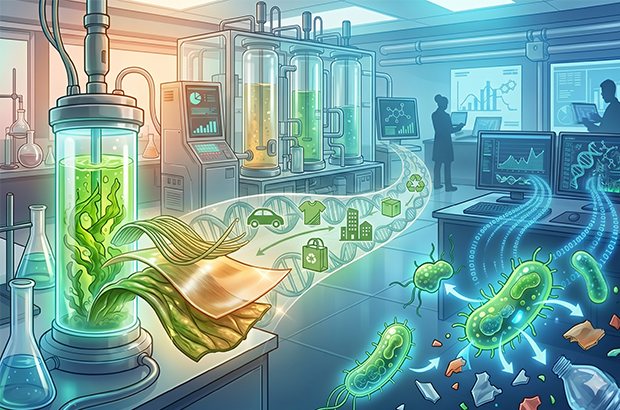

SynBio-Start-up-Report 2026

Biologie ist der neue Code: Wie Synthetische Biologie (SynBio) die Industrie neu programmiert und welche Start-ups dabei hierzulande federführend sind.

Die Vision einer post-fossilen Wirtschaft ist im Jahr 2026 keine bloße Utopie mehr, sondern eine präzise Ingenieursleistung. Wir erleben den Moment, in dem die Natur von einer Ressource, die wir ausbeuten, zu einer Technologie wird, die wir programmieren. In den Laboren der Republik entstehen heute Lösungen für die größten Versorgungskrisen unserer Zeit. Der Aufstieg der Synthetischen Biologie (SynBio) markiert den Übergang vom Zeitalter der Petrochemie in das Zeitalter der Biomanufaktur – eine Transformation, die so tiefgreifend ist wie die industrielle Revolution, jedoch mit der Geschwindigkeit der digitalen Transformation erfolgt.

Wenn Bits auf Atome treffen

Der SynBio-Markt ist 2026 in eine Phase der industriellen Skalierung eingetreten. Aktuelle Analysen der KfW sowie Branchenberichte von BCG beziffern das globale Marktpotenzial für bio-basierte Produkte bis Ende des Jahrzehnts auf über 300 Milliarden Euro. Allein in Deutschland ist das Investitionsvolumen in DeepTech-BioTech-Start-ups im vergangenen Geschäftsjahr laut Bitkom-Daten auf einen Rekordwert von 1,4 Milliarden Euro gestiegen. Der entscheidende technologische Katalysator ist die Verschmelzung von Generativer KI und Biologie. Dank Modellen, die Proteinfaltungen präziser vorhersagen können, als es je ein menschlicher Forscher vermochte, wurde die Entwicklungszeit für neue Enzyme um den Faktor zehn verkürzt. Die Biologie wird damit endgültig zum „Software-Stack“, bei dem Design-Build-Test-Learn-Zyklen in digitalisierten Bio-Gießereien automatisiert ablaufen.

Jenseits der Petrischale: Die Treiber der Bio-Ökonomie

Drei spezifische Sub-Sektoren dominieren in diesem Jahr die Agenda der Investor*innen. An erster Stelle steht die zellfreie Biosynthese, bei der komplexe Moleküle ohne den Einsatz lebender Zellen produziert werden, was die Skalierbarkeit massiv erhöht. Pioniere wie das US-Unternehmen Solugen haben hier den Weg geebnet, doch deutsche Akteure ziehen in der Effizienz der Bioreaktor-Steuerung nach. Ein zweiter massiver Treiber ist das Microbial Carbon Upcycling: Mikroben werden so programmiert, dass sie industrielles CO2 direkt in hochwertige Proteine oder Kunststoffe umwandeln. Hier verschmelzen Klimaschutz und Produktion zu einer Einheit. Drittens sehen wir den Siegeszug der Biomanufaktur bei Alternativmaterialien – sei es durch Biomasse-Fermentation für Lederersatz aus Myzel oder durch echte Präzisionsfermentation, bei der etablierte Akteure wie die bayrische AMSilk zeigen, dass programmierte Spinnenseide-Proteine bereits in Serie gehen können. Die Lieferkette der Mode- und Automobilindustrie wird durch diese Biopolymere radikal dekarbonisiert.

Die harten Lektionen der Skalierung

Der Weg zum Erfolg war jedoch von schmerzhaften Rückschlägen gepflastert. Der prominente Crash des einstigen Branchenlieblings Amyris im Jahr 2023 wirkt bis heute als warnendes Beispiel nach. Das Unternehmen scheiterte trotz Milliardenbewertung an der Komplexität der vertikalen Integration und dem Versuch, gleichzeitig Technologieplattform und B2C-Marke zu sein. Für heutige Gründer*innen haben sich daraus vier fatale Fallstricke herauskristallisiert, die über Sieg oder Niederlage entscheiden. Erstens: Die Ignoranz gegenüber den Unit Economics. Ein Produkt, das im 5-Liter-Maßstab funktioniert, muss im 50.000-Liter-Kessel nicht zwangsläufig profitabel sein. Zweitens: Das „Regulatorik-Vakuum“. Wer die EU-Novel-Food-Verordnungen oder GVO-Richtlinien nicht von Tag eins an in die Produktentwicklung einplant, riskiert Jahre des Stillstands. Drittens: Die Fokussierung auf den Endkonsument*innen statt auf B2B-Integration. Der wahre Hebel liegt in der Lizenzierung von Prozessen an die Industrie. Viertens: Die Unterschätzung der Hardware-Komponente. SynBio ist kein reines Software-Business; ohne Zugang zu physischer Infrastruktur bleibt jede Innovation im Labor gefangen.

Deutschlands Bio-Cluster

Deutschland hat sich im internationalen Vergleich als einer der stärksten Hubs für SynBio etabliert, getrieben durch eine einzigartige Verzahnung von Spitzenforschung und industrieller Basis. In München und dem angeschlossenen IZB Martinsried konzentriert sich die größte Dichte an Venture Capital und Talenten, eng flankiert durch die Exzellenz-Cluster der TU München. Berlin hat sich durch spezialisierte Inkubatoren wie den ProVeg Incubator, Atlantic Food Labs (FoodLabs) und den Science Park Berlin-Buch zum absoluten Zentrum für FoodTech und zelluläre Landwirtschaft entwickelt. Ein weiterer Hotspot ist das Rhein-Neckar-Delta rund um Heidelberg, wo das European Molecular Biology Laboratory (EMBL) und der BioRN-Cluster eine Brücke zwischen Grundlagenforschung und Marktreife schlagen. Aachen punktet mit der RWTH und einer starken Fokussierung auf Bio-Verfahrenstechnik, während der Raum Darmstadt/Frankfurt durch die Nähe zu Giganten wie Merck und die TU Darmstadt als Kraftzentrum für die industrielle Bioproduktion gilt.

Investor*innen-Radar

Die Finanzierungslandschaft hat sich spezialisiert. Wir unterscheiden im Jahr 2026 vier Ebenen der Kapitalgeber*innen. Die spezialisierten VCs wie Forbion, BlueYard Capital oder Sofinnova Partners bringen das notwendige tiefe Domänenwissen mit. Auf der zweiten Ebene stehen Top-Tier Generalisten wie HV Capital und Earlybird, die SynBio zunehmend als Teil ihrer Dekarbonisierungs-Strategie begreifen. Besonders kritisch für die Skalierung sind die Corporate VCs der Industrie, allen voran BASF Venture Capital und Evonik Venture Capital, die nicht nur Geld, sondern auch Abnahmegarantien und technisches Know-how bieten. In der Frühphase bewegen zudem spezialisierte Mikro-Fonds wie Nucleus Capital oder erfahrene ClimateTech-Angels den Markt, oft organisiert in Syndikaten, die das „Valley of Death“ zwischen Labor und Prototyp überbrücken

Die Top-Start-ups: Unsere Must-Watch-Liste 2026

Für die folgende Auswahl der Start-ups haben wir Unternehmen analysiert, die nach 2019 in Deutschland gegründet wurden. Die Auswahlkriterien basieren auf der technologischen Tiefe (IP-Portfolio), dem Reifegrad der Pilotierung, der Validierung durch renommierte Investoren sowie dem Potenzial, bestehende industrielle Lieferketten systemisch zu verändern. Diversität in Gründungsteams und die Skalierbarkeit der zugrunde liegenden Bio-Plattform waren weitere entscheidende Faktoren.

- Cambrium (Berlin, gegründet 2020): Das Team um Dr. Mitchell Duffy nutzt eine KI-gestützte Designplattform, um neuartige Proteine mit molekularen Funktionen zu entwickeln, die in der Natur so nicht vorkommen. Ihr Fokus liegt auf der Kosmetik- und Textilindustrie, wo sie petrochemische Inhaltsstoffe durch bio-designte Alternativen ersetzen. Mit massiven Finanzierungsrunden, angeführt von Tech-Schwergewichten wie Essential Capital und dem Google-KI-Fonds Gradient Ventures, gilt Cambrium als Leuchtturm für eine neue Generation von Biomaterial-Zulieferern, die aus digitalem Code physische Hochleistungsprodukte erschaffen.

- Bluu Seafood (Berlin, gegründet 2020): Gegründet von Dr. Sebastian Rakers und Simon Fabich, ist Bluu einer der führenden europäischen Akteure im Bereich kultivierter Fisch. Durch die Kultivierung echter Fischzellen im Bioreaktor adressieren sie die Überfischung der Meere. Nach signifikanten Investments durch Lead-Investor Sparkfood sowie LBBW VC und Delivery Hero Ventures steht das Unternehmen kurz vor der ersten Marktzulassung in Singapur und den USA.

- Colipi (Hamburg, gegründet 2022): Das Spin-off der TU Hamburg, geführt von Maximilian Webers, nutzt eine patentierte Gasfermentationstechnologie, um CO2 in nachhaltige Öle und Lipide umzuwandeln. Der USP von Colipi ist die Nutzung von industriellen Abgasströmen als Rohstoff, was die Produktion extrem kosteneffizient macht. Sie konnten sich frühzeitig die Unterstützung von Top-Investoren wie dem High-Tech Gründerfonds (HTGF) und dem Innovationsstarter Fonds Hamburg sichern.

- Kynda (Jelmstorf, gegründet 2019): Ursprünglich als Keen 4 Greens von Daniel MacGowan-von Holstein und Franziskus Schnabel gegründet, bietet Kynda Plug-and-Play-Fermentationssysteme für die Lebensmittelindustrie an. Als B2B-Technologiepartner stellen sie modulare Bioreaktoren und Pilzkulturen bereit, mit denen Hersteller ihre eigenen Produktionsabfälle direkt vor Ort kostengünstig in Mykoproteine umwandeln können. Eine kürzliche 3-Millionen-Euro-Seed-Finanzierung – angeführt vom VC EnjoyVenture und massiv flankiert durch ein strategisches Investment des Geflügel-Giganten PHW-Gruppe – unterstreicht das enorme Skalierungspotenzial dieses Kreislauf-Modells.

- Nosh.bio (Berlin, gegründet 2022): Das Team um Tim Fronzek nutzt Pilzbiomasse als funktionalen Inhaltsstoff für die Lebensmittelindustrie, um Clean-Label-Produkte ohne Zusatzstoffe zu ermöglichen. Der technologische Vorsprung von Nosh.bio liegt in der Geschwindigkeit des Fermentationsprozesses. Frühphasen-Finanzierungen durch Earlybird unterstreichen das hohe Vertrauen in das Skalierungspotenzial.

- Ucaneo (Berlin, gegründet 2022): Das Team um Florian Tiller und Carla Glassl beweist, dass Synthetische Biologie auch beim Direct Air Capture (DAC) den Unterschied macht. Statt energieintensiver chemischer Filter nutzt Ucaneo eine biomimetische Technologie: Sie setzen das Enzym Carboanhydrase ein – eines der schnellsten Enzyme der Natur –, um CO2 bei Raumtemperatur direkt aus der Umgebungsluft zu binden. Mit starken Frühphasen-Finanzierungen durch DeepTech-Fonds wie Nucleus Capital und der US-amerikanischen Grantham Foundation baut Ucaneo derzeit in Berlin-Marienfelde ihre erste industrielle Testanlage auf.