Aktuelle Events

Gründer*in der Woche: SeaTable – das Excel der Zukunft

Gründer*in der Woche KW 02/22

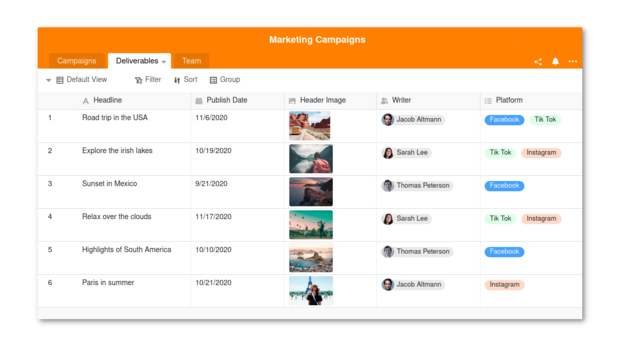

Die Brüder und Gründer von SeaTable – Dr. Ralf Dyllick-Brenzinger und Christoph Dyllick-Brenzinger – wollen die Art und Weise verändern, wie wir künftig Spreadsheets verwenden. In ihrer SaaS-Lösung SeaTable sollen alle privaten oder beruflichen Informationen zusammenlaufen und uns damit eine neue Art des Arbeitens ermöglichen. Mehr dazu im Interview mit Ralf und Christoph.

Wann und wie seid ihr auf die Idee zu SeaTable gekommen?

Ralf: Bevor wir 2014 unser erstes gemeinsames Unternehmen gegründet haben, waren wir beide als Unternehmensberater für große europäische und internationale Unternehmen tätig. Bis dahin hatten wir beide jeweils schon zwei Firmen gegründet, diese aber nur nebenbei betrieben. 2014 haben wir uns dann dazu entschlossen, unsere damaligen Jobs zu kündigen, die bisherigen Firmen links liegen zulassen und uns gemeinsam in die Unternehmerwelt zu stürzen.

Die erste Idee war allerdings nicht die beste. Laut Businessplan hätten wir schon im zweiten Jahr Umsatzmillionäre sein sollen. Daraus ist leider nichts geworden, aber es war der Beginn unserer Reise, die uns dorthin gebracht hat, wo wir heute stehen.

Wir haben jahrelang beobachtet, wie langsam und ineffizient technische Innovationen gelebt werden. Das ist kein typisches deutsches Problem, wobei wir in Deutschland aufgrund der fehlenden Fachkräfte und der konservativen Haltung besonders langsam sind. Daher wollen wir mit SeaTable Teams, Unternehmen und Institutionen jeder Größe und Branche dabei helfen, schnell, einfach und effizient nützliche Anwendungen für Ihre alltäglichen Herausforderungen zu entwickeln.

Was hat euch an bestehenden Lösungen gestört? Es gibt ja bspw. Airtable aus den USA, das hier Maßstäbe setzt …

Christoph: Wie Airtable kommen ein Großteil ähnlicher Lösungen aus dem US-Raum. Fakt ist, dass kein US-Softwarehersteller an europäische Datenschutzbestimmungen gebunden ist. Für viele in Europa angesiedelte Unternehmen ist dies ein nicht zu verachtendes und sehr relevantes Thema bei der Einführung neuer Software-Lösungen. Neben extremer Einhaltung aller europäischen Datenschutzbestimmungen und Serverstandorten in Deutschland bieten wir mit SeaTable neben unserem Cloud-Angebot auch die Möglichkeit einer Installation im eigenen Rechenzentrum an. Damit schaffen wir einen enormen Mehrwert für die Unternehmen, denen es wichtig ist, permanent die eigene Datenhoheit und Kontrolle zu behalten. Zudem heben wir uns mit dieser Möglichkeit klar vom derzeitigen Wettbewerb ab.

Allein aus den eben genannten Gründen finden immer mehr Unternehmen weltweit den Weg zu SeaTable, erkennen die Mehrwerte und vertrauen auf unsere Lösungen. Das macht uns sehr glücklich, stolz und dankbar zugleich.

Was waren die wichtigsten Steps von der Gründung bis zum Go-live von SeaTable?

Ralf: Neben den gängigen Formalitäten der Gründung und der eigentlichen Entwicklung unserer Software bis zum Go-live galt es natürlich auch unseren Auftritt nach Außen, das Team sowie alle internen Mechanismen und Prozesse genauestens zu planen und umzusetzen, sodass wir einen reibungslosen Start im Juli 2020 hinlegen konnten.

Am Anfang haben wir primär an unserer Webseite gearbeitet, Serveranbieter für unser Cloud-Produkt definiert, aber auch bereits die ersten Marketinghebel, Plattformen und Tools in Bewegung gesetzt. Unsere Nutzer sollten sich vom ersten Tag an bestens aufgehoben fühlen und im Mittelpunkt der Entwicklung stehen. Dies macht sich seit Go-live nicht nur durch unsere sehr hohe Nutzer- und geringe Abmelderate bemerkbar, sondern auch durch eine sehr gute Nutzerzufriedenheit über alle gängigen Bewertungsplattformen hinweg.

Dadurch konnten wir bereits mehr als 100.000 Downloads und mehr als 100.000 Cloud-Nutzer verzeichnen, was uns wahnsinnig stolz macht. Zugleich zeigt es uns wie gut unser Produkt in kürzester Zeit angenommen und für Ideen, Aufgaben und Prozesse jeglicher Art verwendet wird.

Auf den Punkt gebracht: Was ist das Besondere an SeaTable, wie unterscheidet ihr euch von anderen SaaS-Lösung in diesem Bereich?

Christoph: SeaTable ist ein Tabellen- und Datenbankhybrid, der ohne Programmierkenntnisse mit den individuellen Bedürfnissen des Nutzers mitwächst und sich hierbei flexibel an die gewünschten Prozesse anpasst. Informationen in Form von Daten aller Art können in unserer Software erfasst, strukturiert, organisiert und ausgewertet werden. Prozesse können im Handumdrehen digitalisiert und Workflows automatisiert werden.

Bildlich gesprochen könnte man auch sagen: SeaTable ist der Software-Baukasten von Lego, mit dem ich mir sofort meine ganz individuellen Prozesse zusammenbauen kann. Dies ermöglicht ein komplett neues und zugleich effizientes Arbeiten im Team.

Mehrere Hunderttausende Datensätze können in unserer Software-Lösung erfasst werden, was bei anderen ähnlichen Produkten auf dem Markt nicht möglich ist. SeaTable ist eine Software, die mit den Anforderungen des Nutzers mitwächst und nicht wie bei vielen angebotenen Lösungen den Nutzer in klar vordefinierte Prozesse zwingen. Zudem kann man SeaTable nicht nur als DSGVO-konformes Cloud-Produkt nutzen, sondern auch im eigenen Rechenzentrum betreiben, was uns einzigartig und zusätzlich im Punkt Datenhoheit für viele Unternehmen sehr attraktiv macht.

Wer ist eure Zielgruppe?

Ralf: SeaTable ist für alle Menschen geeignet, die mit unserem Do-it-yourself Baukasten ohne jegliche Programmiererfahrung in kürzester Zeit effiziente, leistungsfähige, kostensparende Lösungen und Prozesse entwickeln möchten. Unsere Software ist so flexibel entwickelt worden und einsetzbar, dass unser Produkt in jedem Bereich Anwendung finden kann. Startups, KMUs, bis hin zu großen namhaften Unternehmen, Institutionen und Bildungseinrichtungen vertrauen bereits auf SeaTable. Primär findet unsere Software im B2B-Umfeld ihre Anwendung.

Um nur mal ein paar der unendlich vielen Möglichkeiten zu nennen, was mit SeaTable alles möglich ist: Eine Marketingagentur oder -abteilung kann in SeaTable ihre Kreativprozesse vom Brainstorming bis hin zur Umsetzung abbilden. Bauunternehmer und Architekten können Ihre Projekte bis ins Detail planen. Mit SeaTable könnte man auch eine App für entlaufene Tiere entwickeln. Landwirte können die Futter- und Medikamentengabe darin dokumentieren. Ein Designlabel könnte die gesamte Kommunikation zwischen ihren Designern und den Produktionsstätten in Übersee steuern. IT-Abteilungen sind in der Lage, Softwaretests zu überwachen oder Gegenstände wie Beamer und Notebooks zu inventarisieren.

Wie habt ihr die Softwareentwicklung und damit auch euch selbst bislang finanziert?

Christoph: Wir sind komplett eigenfinanziert. Am Anfang konnten wir mit den Einnahmen, die wir mit unserem zweiten Unternehmen, der Datamate GmbH & Co. KG erzielen, alle laufenden Kosten der SeaTable GmbH abdecken. SeaTable wächst nun von ganz allein und kann sich bald komplett selbst tragen.

Wir haben uns bewusst für Bootstrapping entscheiden, da es für uns einfach wichtig ist, unsere eigenen Entscheidungen treffen zu können ohne jeglichen Einfluss von außen. Nur so können wir die notwendige Flexibilität für die schnelle Entwicklung unserer Software-Lösung sicherstellen. Wir wollen nicht schlafen, sondern den Markt aufmischen und bald so bekannt sein wie Excel: SeaTable, das Excel der Zukunft.

Was sind eure weiteren unternehmerischen Vorhaben und Ziele?

Ralf: Wir werden mit SeaTable die aktuellen technischen Grenzen weiter verschieben. Während die Performance aktuell ab 100.000 Zeilen pro Tabelle zurückgeht, wird man Mitte 2022 ohne Probleme Millionen von Zeilen in SeaTable erfassen und speichern können. Zudem wollen wir im kommenden Jahr weitere unmittelbar nutzbare Anwendungen bereitstellen, um die Zugänglichkeit der Lösung weiter zu steigern.

Unser Ziel mit SeaTable ist es, die weltweit führende Low-Code Lösung zu werden, die man sowohl aus der Cloud als auch als selbst gehostete “On-Premises” Version nutzen kann.

Und last but not least: Was wollt ihr anderen Gründer*innen aus eigener Erfahrung mit auf den Weg geben?

Christoph: Es ist wichtig, sich klare Ziele bei der Unternehmensgründung zu setzen, auf die man hinarbeitet. Wichtig hierbei ist es, diese auch in Zeiten von neuen Herausforderungen, internen und externen Einflussfaktoren nicht aus den Augen zu verlieren.

Zudem sollte man seiner eigenen Linie immer treu bleiben und für das stehen, was man auch verkörpert. Es bringt nichts, sich zu verstellen. Das führt mittel- und langfristig eher zu Problemen und kann sich negativ auf den Unternehmenserfolg auswirken. Daher immer authentisch bleiben. Nie vergessen: Die Gründer*innen sind immer das erste Gesicht nach außen.

Zu guter Letzt sollte man immer einen Schritt voraus sein und sich überlegen, ob die eigentliche Idee heute noch den Anforderungen von morgen gerecht werden kann. Falls nicht, sollte man sich Gedanken machen, wie es einem gelingt, Alleinstellungsmerkmale zu schaffen, um immer attraktiv und zugleich unverzichtbar zu bleiben.

Hier geht's zu SeaTable

Das Interview führte Hans Luthardt

Diese Artikel könnten Sie auch interessieren:

Produktivität statt Überstunden: Wie Echtzeitdaten das Finanzwesen von morgen steuern

Das KI-gestützte Fintech Embat beendet das Excel-Chaos im Treasury und macht Finanzteams mit Echtzeitdaten fit für die Zukunft.

Berlin, 28. April 2026 – Es ist ein bekanntes Bild in den Finanz- und Treasury-Abteilungen des deutschen Mittelstands: Wenn der Monatsabschluss naht oder Ad-hoc-Berichte für die Geschäftsführung benötigt werden, bleiben die Schreibtischlampen bis spät in die Nacht an. Die manuelle Zusammenführung von Daten aus unterschiedlichen Bankportalen und historisch gewachsenen Excel-Listen kostet nicht nur Nerven, sondern vor allem wertvolle Zeit.

Das schnell wachsende Fintech Embat tritt an, um genau diesen Engpass aufzulösen. André Reimers, Head of DACH, treibt diese Mission im deutschsprachigen Raum als Gesicht des Unternehmens voran. Seine Kernüberzeugung: Wer heute noch regelmäßig Überstunden machen muss, um finanzielle Transparenz zu schaffen, leidet nicht unter mangelnder Einsatzbereitschaft – er leidet unter einem strukturellen Datenproblem.

Beeindruckendes Wachstum durch das Lösen echter Pain Points

Dass der Schmerz in den Finanzabteilungen groß und der Bedarf an modernen Lösungen riesig ist, belegen die Zahlen, mit denen Embat den europäischen Markt aufrollt. Mit einem starken Kundenwachstum im deutschen Markt von über 250 Prozent im vergangenen Jahr und mittlerweile mehr als 400 mittelständischen und großen Unternehmenskunden weltweit hat sich das Fintech als fester Player etabliert. Das stetig wachsende Transaktionsvolumen von 250 Millionen Euro zeigt deutlich: Der Wechsel von fehleranfälligen Tabellen zu automatisierten Cloud-Lösungen ist in vollem Gange.

Der Weg aus der Excel-Falle

Mit seiner Technologie nimmt Embat den Kampf gegen ineffiziente Prozesse im Treasury auf. Anstatt hochqualifizierte Mitarbeiter mit repetitiver Datenpflege zu binden, automatisiert das System die Konsolidierung aller relevanten Finanzdaten.

„Die Erwartungshaltung, dass komplexe Finanzanalysen zwingend mit langen Abenden im Büro einhergehen müssen, ist schlichtweg nicht mehr zeitgemäß“, erklärt André Reimers. „Wenn Cashflow, Liquidität und Runways per Knopfdruck in Echtzeit abrufbar sind, ändert sich die gesamte Arbeitsdynamik. Finanzteams können aus dem reaktiven Modus heraustreten und sich auf die strategische Steuerung des Unternehmens konzentrieren.“

Hohe Innovationskraft trifft auf lokales DACH-Verständnis

Embat profitiert von einer enormen Innovationsgeschwindigkeit und Agilität, auf der die starke technologische Basis des Unternehmens beruht. Wie diese passgenau auf die spezifischen Bedürfnisse des deutschen Marktes übersetzt wird und für eine hohe lokale Marktpräsenz sorgt, zeigt André Reimers an den Standorten in München und Berlin.

Von diesen beiden Standorten aus steuert André Reimers das DACH-Geschäft und stellt das tiefe Verständnis für die komplexen Strukturen und hohen Sicherheitsbedürfnisse des deutschen Mittelstands sicher. Das Team zeigt dabei, wie moderne, dezentrale Zusammenarbeit erfolgreich funktioniert. Das Vertrauen der stetig wachsenden deutschen Kundenbasis fußt dabei auf dieser geballten lokalen Expertise gepaart mit der unerschütterlichen Zuverlässigkeit der Systeme.

Führen durch Resultate, nicht durch Anwesenheit

Die Botschaft an die Finanzwelt ist klar: Moderne Führung, hohe Produktivität und Skalierbarkeit erfordern keine starren Kontrollmechanismen oder endlosen Arbeitstage. Sie erfordern radikale Datentransparenz und die richtigen digitalen Werkzeuge. Wenn die Daten in Echtzeit fließen, sinkt die Fehlerquote, die Entscheidungsgeschwindigkeit steigt – und die systembedingten Überstunden im Treasury gehören endgültig der Vergangenheit an.

Über Embat:

Embat ist ein KI-gestütztes FinTech mit Schwerpunkt auf Treasury-Management, das es mittelständischen Unternehmen und Großkonzernen ermöglicht, ihre Finanzprozesse in Echtzeit zu zentralisieren. Gegründet von Antonio Berga und Carlos Serrano – ehemaligen J.P. Morgan-Managern mit umfassender Erfahrung im Corporate Banking – sowie Tomás Gil, dem ehemaligen CTO von Fintonic, entstand die Plattform mit der Mission, die Finanzabteilung zu digitalisieren. Die klare Prämisse dabei: Technologie von Finanzexperten für Finanzexperten.

Durch seine hybride Konnektivität lässt sich Embat in über 15.000 Banken und führende ERP-Systeme integrieren und beseitigt so jegliche Datenfragmentierung. Das wichtigste Alleinstellungsmerkmal ist TellMe, ein „Agentic Treasury Analyst“ (autonomer KI-Analyst), der Cashflow-Muster erkennt, komplexe Kontenabstimmungen automatisiert und strategische Entscheidungen zur Optimierung der Liquidität vorschlägt.

Mit Niederlassungen in Madrid, London, Berlin und München definiert Embat die Zukunft des Corporate Finance neu.

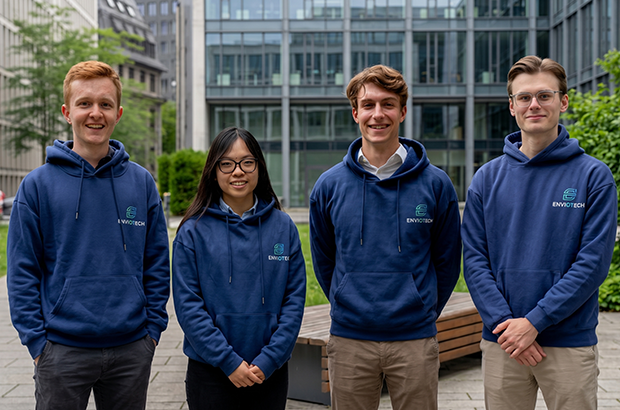

ENVIOTECH sichert sich Millionenfinanzierung für intelligente öffentliche Straßenbeleuchtung

Das Frankfurter Start-up ENVIOTECH rund um Adrian Rhaese, Linh Pham, Dustin Arnold und Peter Kletsko hat eine Pre-Seed-Runde in Höhe von einer Million Euro abgeschlossen, um öffentliche Straßenbeleuchtung intelligent nachzurüsten. Doch der Markt für kommunale Infrastruktur ist hart umkämpft und bürokratisch. Kann das junge Team die öffentlichen Verwaltungen überzeugen?

Es ist ein klassisches Gründer*innen-Narrativ: Aus einem persönlichen Schmerzpunkt entsteht eine Geschäftsidee. Im Fall von ENVIOTECH war es ein Fahrradunfall. Der beste Freund von Mitgründer Adrian Rhaese verunglückte, weil in einer deutschen Stadt die Straßenlaternen aufgrund gestiegener Stromkosten abgeschaltet worden waren. Dieser Vorfall weckte bei Rhaese das Unverständnis darüber, dass in einem wirtschaftlich starken Land ausgerechnet an der Sicherheit gespart wird – und legte den Grundstein für das Smart-City-Start-up.

Bye-bye Bankenturm: Der Sprung ins kalte Wasser

Anstatt ihren als sicher geltenden Karriereweg fortzusetzen, verließen Adrian Rhaese und Mitgründerin Linh Pham ihre Positionen als duale Studierende bei der Deutschen Bank. Sie entschieden sich bewusst für das unternehmerische Risiko, um reale Infrastrukturprobleme zu lösen.

Eine erste Bestätigung für diesen Schritt erhielt das junge Team durch die Aufnahme in das EWOR Fellowship. Daniel Dippold, Gründer und CEO von EWOR, bescheinigt dem Team den richtigen Fokus: „Unspektakuläre Infrastruktur gewinnt langfristig fast immer. Straßenbeleuchtung ist nicht glamourös, aber sie ist allgegenwärtig, unverzichtbar und aus keiner Stadt wegzudenken.“

Plug-and-Play am Lichtmast: Das 15-Minuten-Update

Die technische Lösung von ENVIOTECH setzt auf Pragmatismus: Anstatt Laternen kostenintensiv komplett auszutauschen, bietet das Unternehmen ein Retrofit-System an. Das Produkt soll sich laut Unternehmensangaben in unter 15 Minuten in bestehende Leuchten integrieren lassen.

Die nachgerüsteten Laternen kommunizieren als Mesh-Netzwerk miteinander und dimmen das Licht KI-gesteuert und bedarfsgerecht anhand von Bewegungserkennung. Das Startup verspricht dadurch Energieeinsparungen von bis zu 80 Prozent; gleichzeitig soll die öffentliche Sicherheit erhöht werden. Kommunen erhalten so die Möglichkeit, ihre Beleuchtung zentral zu steuern und in Echtzeit zu überwachen.

Um das Konzept in die Fläche zu tragen, konnte ENVIOTECH nun eine Pre-Seed-Finanzierung in Höhe von 1 Million Euro einsammeln. Angeführt wird die Runde passenderweise vom ehemaligen Co-CEO der Deutschen Bank, Jürgen Fitschen. Ergänzt wird das Konsortium durch Ex-MAN-CEO Joachim Drees, Alexander Eyhorn (Gründer von Bidirex) und Danilo Jovicic-Albrecht (Mitgründer des auf Kommunen spezialisierten Startups Vialytics). Mit dem frischen Kapital sollen Pilotprojekte forciert und das Technologieportfolio weiterentwickelt werden.

Der Endgegner heißt B2G-Markt: David gegen die Industrie-Goliaths

So einleuchtend die Technologie klingt, das Geschäftsmodell von ENVIOTECH steht vor gewaltigen Hürden. Der B2G-Markt (Business-to-Government) ist für Start-ups extrem schwierig. Kommunen, die ENVIOTECHs primäre Zielgruppe darstellen, arbeiten mit langen Budgetzyklen und streng regulierten öffentlichen Ausschreibungsverfahren. Bis ein Pilotprojekt zu einem flächendeckenden Rollout führt, vergehen oft Jahre.

Darüber hinaus agiert das Start-up nicht im luftleeren Raum. Der Smart-Lighting-Markt wird von Industriegiganten wie Signify oder Schréder dominiert, die längst eigene IoT-Lichtsteuerungssysteme anbieten. Auch andere Start-ups wie Tvilight oder Icegateway haben das Potenzial vernetzter Straßenbeleuchtung erkannt.

Der entscheidende USP von ENVIOTECH muss daher in der Geschwindigkeit und Einfachheit liegen: Gelingt die versprochene rasante Installation und können Kommunen die Lösung ohne massive Tiefbauarbeiten testen, hat das Start-up einen echten Wettbewerbsvorteil. Besonders klug ist hierbei die Auswahl der Investor*innen: Mit Drees und Jovicic-Albrecht hat das Gründerduo Köpfe an Bord geholt, die wissen, wie man komplexe Produkte an die öffentliche Hand verkauft. Schafft es ENVIOTECH, den extrem zähen Vertriebszyklus öffentlicher Verwaltungen zu knacken, könnte das Unternehmen zu einem hochrentablen Hidden Champion heranwachsen.

Primogene: 4,1 Mio. Euro für den Muttermilch-Code – Deep-Tech-Innovation oder riskantes Unterfangen?

Das Leipziger BioTech-Start-up Primogene hat eine Seed-Finanzierung in Höhe von 4,1 Mio. Euro eingesammelt, um komplexe bioaktive Moleküle im industriellen Maßstab auf den Markt zu bringen.

Während die Unternehmenskommunikation den Durchbruch einer neuen Plattformtechnologie feiert, zeigt ein genauerer Blick auf den globalen Markt für humane Milcholigosaccharide (HMOs) ein Haifischbecken voller multinationaler Konzerne. Eine kritische Analyse des Geschäftsmodells, der Gründer*innen und des Wettbewerbs.

DeepTech Made in Leipzig

Hinter Primogene stehen Dr.-Ing. Reza Mahour (CEO), Valerian Grote und Linda Karger (COO), die das Unternehmen 2023 in Leipzig gründeten. Die Zusammensetzung des Teams vereint technologische und wissenschaftliche Expertise, um die ehrgeizige Vision einer industriellen Enzym-Produktion umzusetzen. Die aktuelle, 4,1 Millionen Euro starke Seed-Runde wird vom High-Tech Gründerfonds (HTGF) angeführt. Zum Investoren-Konsortium gehören außerdem der Technologiegründerfonds Sachsen (TGFS), better ventures, die Sächsische Beteiligungsgesellschaft (SBG), die Golzern Holding GmbH, die FS Life Science Investment GmbH sowie Dr. Marc Struhalla, Gründer und CEO der c-LEcta GmbH. Der Kapitaleinsatz ist klar definiert: Die neuen Mittel fließen in den Ausbau des IP-Portfolios, die Erweiterung der Produktionskapazitäten in Leipzig und in strategische Partnerschaften.

Das Modell im Stresstest: Die Kostenfalle der Enzyme

Primogene hat eine enzymatische Plattformtechnologie entwickelt, um Inhaltsstoffe zu produzieren, die identisch zu natürlichen Molekülen sind – nachhaltig und kosteneffizient. Im Zentrum stehen dabei komplexe humane Milcholigosaccharide (HMOs) wie Disialyllacto-N-Tetraose (DSLNT) und Difucosyllacto-N-Tetraose I (LNDFH I). Laut Primogene verursachen etablierte fermentative Herstellungsverfahren erhebliche Kosten und stoßen bei der Produktion derartiger hochkomplexer Moleküle an ihre Grenzen.

Der Lackmustest: Die Prämisse, dass enzymatische Verfahren in der Massenproduktion überlegen sind, birgt in der Praxis massive Hürden. Die Entwicklung und wirtschaftliche Produktion der benötigten Enzyme selbst ist extrem kapitalintensiv. Dass das Start-up den gesamten Prozess – von der Enzymentwicklung über die Produktion und Biotransformation bis zur Aufreinigung – komplett am eigenen Unternehmensstandort in Leipzig abbilden will, ist ein ambitionierter, aber riskanter Schritt. Der Aufbau eigener Produktionsanlagen für komplexe BioTech-Prozesse führt oft zu einer enorm hohen Kapitalverbrennungsrate (Burn Rate).

Erste kommerzielle Meilensteine dämpfen dieses Risiko jedoch: Erste Inhaltsstoffe für Kosmetikprodukte wurden mit Kooperationspartnern entwickelt und sind bereits kommerziell erhältlich. Auch pharmazeutische Rohstoffe befinden sich aktuell im Test bei Kund*innen. Zudem erforscht das Unternehmen in Zusammenarbeit mit dem Fraunhofer-Institut für Zelltherapie und Immunologie (IZI) in Leipzig das Potenzial seiner Inhaltsstoffe zur Prävention von Infektionskrankheiten.

Im Haifischbecken: Auf Kollisionskurs mit den Lebensmittel-Riesen

Der Zielmarkt ist hochattraktiv: Der globale HMO-Markt wächst jährlich um etwa 18 bis 20 Prozent, und über 65 Prozent der im Jahr 2023 neu eingeführten Säuglingsnahrungsprodukte enthielten mindestens ein HMO. Neben der Säuglingsernährung bedient Primogene auch Märkte wie die Darmgesundheit bei Erwachsenen, die Gedächtnisverbesserung im Alter sowie funktionale Inhaltsstoffe für Körperpflege und pharmazeutische Rohstoffe.

Das Leipziger Team trifft in der Nahrungsmittelindustrie jedoch auf einen extrem konsolidierten Markt, der von Milliarden-Konzernen dominiert wird. Einer der größten B2B-Zulieferer für Säuglingsnahrung weltweit ist DSM-Firmenich (mit der übernommenen Sparte Glycom), der den Markt durch gigantische Größenvorteile (Economies of Scale) in der Fermentation beherrscht. Auch Chr. Hansen (Jennewein), ein Pionier in der mikrobiellen HMO-Synthese, stellt mit seiner extrem tiefen Integration bei Lebensmittelriesen einen massiven Konkurrenten dar. Auf der Abnehmerseite agieren Endkonsument*innen-Giganten und Branchenführer wie Nestlé und Abbott, bei denen für einen neuen Zulieferer von Inhaltsstoffen extrem hohe regulatorische und volumenbasierte Hürden bestehen.

Primogenes strategische Nische: Ein Preiskampf bei einfach strukturierten Standard-HMOs gegen die großen Fermentations-Player wäre für ein Start-up kaum zu gewinnen. Primogenes entscheidender Wettbewerbsvorteil liegt jedoch in der Komplexität. Die industrielle Produktion von Molekülen wie DSLNT – das laut klinischen Studien signifikante gesundheitliche Vorteile speziell für Frühgeborene bietet – war bislang schlicht nicht möglich. Wenn Primogene hier durch sein starkes Patentportfolio die technologische Lücke schließt, umgeht das Unternehmen den harten Konkurrenzkampf im Massenmarkt.

Unser Fazit: Hohes Risiko, riesiger Hebel

Primogene ist kein schlankes Software-Projekt, sondern waschechtes DeepTech. Das bedeutet: Hohe regulatorische Hürden, langer Atem in der Forschung und massive Kapitalanforderungen. Die Seed-Finanzierung in Höhe von 4,1 Millionen Euro ist ein starker Vertrauensbeweis erfahrener Investoren, wird für den Anlagenbau und die Skalierung der Leipziger Produktion auf Dauer jedoch kaum ausreichen. Primogene muss nun rasch beweisen, dass die enzymatische Synthese nicht nur technologisch überlegen, sondern auch unter realen industriellen Kostendrücken skalierbar ist. Gelingt dieser Proof of Concept, hält das Start-up den Schlüssel zu einer neuen Generation komplexer, bioaktiver Moleküle in der Hand.

110-Mio.-Dollar-Turbo: Sereact verpasst Robotern eine Vorstellungskraft

Mit 110 Mio. Dollar frischem Kapital und „Cortex 2“ greift das Stuttgarter Start-up Sereact die USA an. Die Vision: Roboter, die physikalisch mitdenken, statt nur blind zuzugreifen.

Das 2021 gegründete Stuttgarter Start-up Sereact hat in einer aktuellen Serie-B-Finanzierungsrunde 110 Millionen US-Dollar eingesammelt. Mit dem Versprechen, Industrierobotern durch sogenannte „Weltmodelle“ eine Art situative Vorstellungskraft zu verleihen, zieht das Unternehmen erneut internationale Schwergewichte an. Doch während die Kriegskasse für die anstehende US-Expansion prall gefüllt ist, stellt sich die Frage: Kann der datengetriebene Ansatz aus dem Schwabenland die hochfinanzierte US-Konkurrenz auf ihrem Heimatmarkt wirklich ausstechen? Eine Analyse.

Millionen-Spritze für den Weltmarkt

Die Gründungsgeschichte von Sereact liest sich wie ein europäischer Tech-Traum. Ralf Gulde (CEO) und Marc Tuscher (CTO) starteten 2021 als Ausgründung der Universität Stuttgart. Was mit improvisierten Servern aus gebrauchten Grafikkarten begann, hat sich zu einem globalen Geschäft entwickelt: Nach einer Serie-A-Runde im Jahr 2025 führt nun der VC Headline die 110-Millionen-Dollar-Runde an. Beteiligt sind zudem Bullhound Capital, Daphni und Felix Capital, womit das Gesamtkapital auf über 140 Millionen US-Dollar steigt.

Der Grund für das massive Interesse liegt in der Skalierbarkeit: Mit über 200 europaweit eingesetzten Systemen gilt Sereact als einer der am häufigsten eingesetzten Anbieter von KI-Kommissionierrobotern. Die Kundenliste umfasst Größen wie BMW, Mercedes-Benz, DHL, PepsiCo und die Österreichische Post.

Cortex 2: Denken vor dem Greifen

Bisher basierte der Erfolg auf der Koppelung von Sprachmodellen und Bilderkennung. Mit der neuen Generation „Cortex 2“ geht Sereact einen Schritt weiter: Das System erweitert ein Vision-Language-Action-Modell (VLA) um ein „Weltmodell“. Anstatt nur zu reagieren, gleicht die KI Aktionen mit einem erlernten Modell der Physik ab und wählt den vielversprechendsten Weg aus.

Dieser Wechsel vom Reagieren zum Schlussfolgern ermöglicht komplexe Aufgaben, bei denen feinfühliger Kontakt entscheidend ist – etwa das Zusammenbauen von Komponenten unter Spannung oder das kratzerfreie Anbringen eines Scheibenwischers. CTO Marc Tuscher betont: „Wir bauen keine Roboter. [...] Die Hardware wird zur Massenware. Das Modell nicht.“

Der Eine-Milliarde-Picks-Vorsprung

Sereact positioniert sich als reines Software-Unternehmen, sieht seinen entscheidenden Vorteil jedoch in der Datenqualität. Ein kritischer Blick auf den Markt zeigt:

- Reale Daten vs. Simulation: Während viele Wettbewerber mit simulierten Daten trainieren, wurde Cortex 2 auf Basis von mehr als einer Milliarde realer Greifvorgänge aus der Produktion entwickelt.

- Nachgewiesene Präzision: Sereact begegnet der Skepsis gegenüber KI in der Logistik mit harten Zahlen. Laut Unternehmen erfordert nur noch jeder 53.000. Kommissioniervorgang ein menschliches Eingreifen.

- Hardware-Abhängigkeit: Trotz der Software-Stärke bleibt Sereact darauf angewiesen, dass Kunden in moderne Roboterarme und Sensorsysteme wie die hauseigene „Sereact Lens“ investieren.

Showdown in den USA

Mit der Präsentation auf der MODEX in Atlanta und der geplanten Eröffnung eines Büros in Boston in diesem Sommer bläst Sereact zum Angriff auf den US-Markt. Amerikanische Hersteller fordern produktreife KI, die sofort einsatzbereit ist.

Für die Gründer*innenszene sendet Sereact ein klares Signal: Der nächste Paradigmenwechsel der KI findet in der physischen Welt statt (Embodied AI). Der Erfolg in den USA wird davon abhängen, ob das Stuttgarter Daten-Flywheel auch gegen die gigantischen Budgets der US-Konkurrenz bestehen kann. Sereact hat den Grundstein gelegt, um das „Gehirn“ der globalen Automatisierung zu werden.

Omegga sichert 10 Mio. EUR gegen das Kükentöten

Das 2020 gegründete Münchner Start-up Omegga sichert sich Seed-Kapital für seine optische KI-Spektroskopie. Unsere Marktanalyse.

Omegga wurde 2020 von Katharina Hesseler, Till Nöllgen und Paul Günther gegründet. Zum erweiterten Gründer:innenkreis gehören zudem Moritz Eder, Kyle Hiroyasu und Clara Kaufhold. Das Team bündelt Expertise in den Bereichen KI, Optik und industrielle Systeme. In den vergangenen Jahren entwickelte das Team seine Technologie kontinuierlich vom Prototypen zum Industriestandard weiter und konnte sich bereits 2023 eine Pre-Seed-Finanzierung sowie 2024 Fördermittel des European Innovation Council (EIC) sichern.

CEO und Mitgründerin Katharina Hesseler sieht in dem Einstieg der neuen Partner, die „tiefes technologisches Verständnis mitbringen“, ein „starkes Signal für das enorme Potenzial unseres Ansatzes, einen neuen Standard in der Industrie zu setzen“. Das frische Kapital soll in den gezielten Ausbau des Teams und die kommerzielle Skalierung der Technologie fließen.

Das Problem und die technologische Lösung

Der erste und bereits kommerziell verfügbare Use Case von Omegga widmet sich einem der massivsten ethischen Probleme der modernen Landwirtschaft. Jährlich werden weltweit Milliarden männlicher Küken direkt nach dem Schlüpfen getötet, da sie weder Eier legen noch für die Masthaltung wirtschaftlich nutzbar sind.

Mit der sogenannten spektralen Intelligenz – der Kombination aus KI und Spektroskopie – will Omegga das Unsichtbare sichtbar machen. Im Gegensatz zu vielen Marktbegleitern wählt Omegga einen rein optischen, nicht-invasiven Weg. Durch spezielle Kameras und Lichtfrequenzen werden die Eier im Brutkasten gescannt. Laut eigenen Angaben bietet das Start-up damit die früheste am Markt kommerziell verfügbare Technologie, um das Geschlecht noch vor dem Schlüpfen zu bestimmen. Das System ist bereits bei Kund*innen im laufenden industriellen Produktionsbetrieb im Einsatz.

Markt, Wettbewerb & regulatorischer Druck

Der Markt für das „In-Ovo-Sexing“ wächst rasant, primär getrieben durch den Gesetzgeber. In Deutschland ist das Kükentöten seit 2022 gesetzlich verboten, Frankreich zog nach, und ein EU-weites Verbot wird debattiert. Der Zwang zur Adaption in den Brütereien ist entsprechend hoch.

Omegga tritt in ein Feld ein, das bereits von finanzstarken Konkurrenten besetzt ist:

SELEGGT: Gilt als früher Pionier auf dem Markt. Das Unternehmen nutzt hormonelle Tests am 9. Bruttag, wofür das Ei mittels eines Lasers winzig klein geöffnet werden muss (minimal-invasiv).

In Ovo: Das niederländische Unternehmen setzt auf Flüssigkeitsanalysen mittels Massenspektrometrie am 9. Bruttag und sicherte sich erst kürzlich ein 42-Millionen-Euro-Darlehen der Europäischen Investitionsbank (EIB).

Agri Advanced Technologies (AAT): Die Tochter der EW Group dominiert weite Teile des Marktes mit hyperspektraler Bildgebung, die primär für braune Eier zwischen dem 11. und 13. Tag genutzt wird.

Der entscheidende Vorteil von Omegga: Die Methode kommt völlig ohne Verbrauchsmaterialien wie Chemikalien oder feine Nadeln aus. Da die Eier bei der rein optischen Methode unversehrt bleiben, entfällt das systembedingte Kontaminationsrisiko, das bei invasiven Verfahren entstehen kann.

Unsere Einordnung

Trotz der vielversprechenden Technologie steht Omegga vor Herausforderungen:

Hardware-Skalierung in rauen Umgebungen: Die Systeme müssen in den feuchten, warmen und staubigen Inkubatoren industrieller Brütereien über Jahre hinweg wartungsarm laufen. Hier muss das Start-up beweisen, dass sich die Technologie reibungslos in den globalen Massenbetrieb integrieren lässt.

Der regulatorische „Faktor Zeit“: Rein optische Modelle benötigen oft bis zum 12. Tag für eine verlässliche Auswertung. Sollte die Politik die „Tag 6“-Frist künftig strikt durchsetzen, müssen die KI-Modelle von Omegga beweisen, dass sie derart früh hochpräzise Ergebnisse liefern.

Die Plattform-Vision – Fluch oder Segen?

Omegga positioniert seine Lösung ausdrücklich als Plattformtechnologie für die Landwirtschaft, Lebensmittelproduktion und industrielle Qualitätskontrolle. Wie stark dieses Narrativ bei den Geldgebern verfängt, zeigen die Statements zur aktuellen Runde: Laut Christian Knott (Capnamic) entsteht hier eine Technologie „mit dem Potenzial, gleich mehrere Industrien grundlegend zu verändern“. Auch Mason Sinclair (IQ Capital) lobt die Schaffung einer „Plattform für die nicht-invasive und branchenübergreifende Materialanalyse“.

Dass solche Visionen bei Investor*innen beliebt sind, da sie den adressierbaren Markt massiv vergrößern, ist nachvollziehbar. Für ein 17-köpfiges Start-up birgt die gleichzeitige Erschließung neuer Industriezweige jedoch die Gefahr einer operativen Verzettelung. Der Fokus muss zunächst darauf liegen, den Geflügelmarkt zu durchdringen.

Fazit

Gelingt es Omegga, die rein optische Methode in der Breite zu skalieren und die Genauigkeit auf die allerersten Bruttage zu trainieren, hat das Münchner Start-up einen signifikanten Hebel gegen invasiv arbeitende Wettbewerber. Die 10-Millionen-Euro-Runde ist ein klarer Vertrauensbeweis der Investor*innen in einem schwierigen Funding-Umfeld.

M&A im CleanTech-Sektor: SpotmyEnergy übernimmt Zählerhelden

Das 2023 von Jochen Schwill gegründete Kölner Start-up SpotmyEnergy übernimmt den kompletten Messstellenbetrieb des Mitbewerbers Zählerhelden und sichert sich damit rund 3.000 Smart Meter. Der Schritt markiert nicht nur anorganisches Wachstum, sondern verdeutlicht die beginnende Konsolidierung im deutschen Smart-Meter-Markt. Ein genauerer Blick auf die Macher, das Geschäftsmodell und einen Markt, der notorisch hinterherhinkt.

Hinter SpotmyEnergy steht mit Jochen Schwill ein prominenter Kopf der deutschen Energie-Start-up-szene. Schwill, bekannt als Gründer des virtuellen Kraftwerks Next Kraftwerke, rief das CleanTech-Startup im Jahr 2023 in Köln ins Leben. SpotmyEnergy agiert als unabhängiger, wettbewerblicher Messstellenbetreiber. Das Ziel des Unternehmens ist es, den in Deutschland stockenden Ausbau von intelligenten Messsystemen entscheidend zu beschleunigen.

Das Zuhause als virtuelles Kraftwerk

Das reine Aufhängen von Stromzählern ist in einem stark regulierten Markt kaum profitabel. SpotmyEnergy umgeht diese Falle durch einen ganzheitlichen Plattform-Ansatz:

- Hardware & Software: Das Startup liefert Lösungen zur Messung, Vernetzung, Optimierung und Steuerung von Photovoltaikanlagen, Wärmepumpen, Heimspeichern und Wallboxen.

- Drei-Säulen-Modell: Das Unternehmen fungiert als Messstellenbetreiber zur Bereitstellung von Smart Metern, als Energiemanager zur Kostenoptimierung der vernetzten Geräte und als Lieferant mit einem dynamischen Tarif, der Zugang zu aktuellen Börsenstrompreisen bietet.

- B2B2C-Vertrieb: Für den Rollout der Lösungen setzt SpotmyEnergy auf ein Partnernetzwerk, das seit der Firmengründung auf über 300 Elektroinstallationsbetriebe angewachsen ist.

Kritische Hinterfragung

Der Erfolg dieses Modells hängt maßgeblich von der fehlerfreien technischen Integration ab. SpotmyEnergy leistet aktuell Pionierarbeit bei der Einbindung von Steuerboxen, die in Deutschland bislang noch wenig verbreitet sind. Eine Übertragung derartiger Boxen in der aktuellen Größenordnung von 3.000 Stück hat es auf dem deutschen Markt bislang nicht gegeben. Die kritische Frage lautet: Funktionieren die technischen Schnittstellen dauerhaft und herstellerübergreifend reibungslos? Laut Geschäftsführer Schwill wurde mit der Etablierung der technischen Prozesse nun der Grundstein dafür gelegt, dass ein solcher Steuerboxwechsel in der Praxis überhaupt umsetzbar ist.

Markt & Wettbewerb

Deutschland ist beim Thema Smart Meter das Sorgenkind Europas; die Marktdurchdringung ist extrem gering. Dennoch drängen derzeit starke Wettbewerber*innen in die Nische, um sich die digitale Schnittstelle zum Kunden / zur Kundin für die Energiewende zu sichern:

- metrify: Die Enpal-Ausgründung ist mit über 65.000 installierten Systemen der Platzhirsch unter den wettbewerblichen Messstellenbetreibern.

- Inexogy & LichtBlick: Diese Anbieter kooperieren stark mit großen dynamischen Stromanbietern oder agieren als etablierte Ökostrom-Versorger mit eigenen Messstellen-Lösungen.

- Energy Metering Germany (Octopus Energy): Setzen auf gebündelte Angebote, oft gekoppelt an ihre eigenen intelligenten Tarife.

Unsere Einordnung

Die Übernahme des Zählerhelden-Portfolios ist ein strategischer Befreiungsschlag. Für die Kunden von Zählerhelden läuft der Betrieb laut Unternehmensangaben ohne Unterbrechung weiter, sie müssen keine eigenen Schritte einleiten. Die bisherigen Zählerhelden-Gesellschafter, ABM-Mess Service und BSH, konzentrieren sich künftig wieder stärker auf ihre jeweiligen Kerngeschäfte.

Ein hardwarebasiertes, stark reguliertes Geschäftsmodell erfordert extrem tiefe Taschen. SpotmyEnergy wird hierbei vom Investitions- und Strukturierungspartner Horizon Energy Deutschland flankiert, der das Start-up seit Ende des vergangenen Jahres bei der Skalierung unterstützt. Horizon stellt Kapital in Höhe von über 50 Millionen Euro für Smart-Meter-Assets zur Verfügung. Ein Teil dieser zugesicherten Mittel fließt nun direkt in die Übernahme der rund 3.000 Smart Meter von Zählerhelden. Genaue Angaben zum Kaufpreis oder den weiteren finanziellen Übernahmemodalitäten der Transaktion machen die beteiligten Unternehmen jedoch nicht. Wie Emil Bruusgaard, Geschäftsführer von Horizon Energy Deutschland, dennoch treffend analysiert, verdeutlicht die Transaktion anschaulich, wie sich fragmentierte Strukturen im Markt gezielt konsolidieren lassen, um die Grundlage für weiteres Wachstum zu schaffen.

Fazit

Jochen Schwill versucht mit SpotmyEnergy im Endkund*innenbereich das, was ihm im Industriebereich bereits gelang: die digitale Bündelung dezentraler Energieflüsse. Der Zukauf von Zählerhelden beweist eindrucksvoll, dass anorganisches Wachstum in dieser Branche ein essenzieller Hebel ist. Der wettbewerbliche Messstellenbetrieb bietet für ambitionierte Start-ups weiterhin enormes Entwicklungspotenzial.

11 Mio. USD für VisioLab: Stürzt ein Osnabrücker Start-up die Kassen-Dinos?

Das Start-up VisioLab der Gründer an Tim Niekamp und Iwo Gernemann hat den Kassen-Dinos den Kampf angesagt, in dem es den Checkout in Mensen und Arenen durch simple iPad-KI automatisiert.

In der Systemgastronomie, in Mensen und Stadien ist der größte Engpass oft nicht die Küche, sondern die Kasse. Das Osnabrücker Start-up VisioLab adressiert dieses Problem mit künstlicher Intelligenz und verwandelt handelsübliche iPads in voll funktionsfähige Self-Checkout-Systeme. Für die weitere globale Skalierung hat das Unternehmen nun eine Series-A-Finanzierung in Höhe von 11 Millionen US-Dollar abgeschlossen. Angeführt wird die Runde von eCAPITAL Entrepreneurial Partners und Simon Capital, unterstützt von bestehenden Investor*innen wie dem High-Tech Gründerfonds, APX, dem Family Office zwei.7 und Business Angels wie Jens Ohr. Doch wie robust ist dieses scheinbar simple Geschäftsmodell im hart umkämpften Markt der Kassenautomatisierung wirklich?

Aus der Mensa in die NBA: Die Köpfe hinter dem Kassen-Killer

Gegründet wurde VisioLab im Jahr 2019 in Osnabrück von CEO Tim Niekamp und President & COO Iwo Gernemann. Die Idee entsprang einem stark spürbaren Schmerzpunkt in der Gastronomie: Zur Mittagszeit oder in der Halbzeitpause stauen sich die Gäste, während herkömmliche Kassensysteme oft im fünfstelligen Preisbereich liegen und aufwendig geschultes Personal erfordern. Zudem verschärft der chronische Personalmangel in der Foodservice-Branche die Lage massiv.

Die Vision der Gründer war von Beginn an, den Checkout-Prozess durch KI so drastisch zu vereinfachen, dass die zugrundeliegende Technologie im Betrieb kaum noch als solche wahrgenommen wird. Mit einem aktuellen Team von rund 25 Mitarbeitern an den Standorten Osnabrück und Boston haben Niekamp und Gernemann das System iterativ zur Marktreife geführt und internationalisiert. Das frische Kapital soll nun genutzt werden, um das Team auf etwa 40 Mitarbeiter auszubauen – gezielt verstärkt durch ehemalige Führungskräfte von Klarna, SumUp und Google.

Ein iPad als Kassensystem: Geniestreich oder Achillesferse?

Die technische Umsetzung besticht durch Hardware-Minimalismus. VisioLab eliminiert teure, proprietäre Scanner-Kassen und setzt stattdessen auf ein Apple iPad samt Kamera, kombiniert mit einem kompakten Bluetooth-Bezahlterminal und der eigenen KI-App. Die KI erkennt Speisen und Getränke auf dem Tablett in Echtzeit – unabhängig davon, ob diese verpackt oder lose sind. VisioLab vertreibt dieses Setup als "Plug-and-Play"-Lösung direkt als E-Commerce-Produkt über einen Online-Shop. Ein einziges Foto genügt laut Unternehmensangaben, um der KI ein neues Produkt beizubringen, wodurch das System in weniger als fünf Minuten startklar sein soll.

Die fundamentalen Zahlen belegen, dass diese Strategie derzeit voll aufgeht:

- Transaktionen: Weltweit verarbeiten rund 500 Installationen etwa eine Million Transaktionen im Monat.

- Gesamtvolumen: Das kumulierte Transaktionsvolumen liegt mittlerweile bei knapp 100 Millionen US-Dollar.

- Wirtschaftlichkeit: Im vergangenen Quartal verzeichnete das Unternehmen erstmals einen positiven Cashflow.

Kritisch hinterfragt

Der Verzicht auf stark spezialisierte Hardware ist ein zweischneidiges Schwert. Einerseits ermöglicht es VisioLab eine enorme Vertriebsgeschwindigkeit ohne große Hardware-Vorfinanzierungen und langwierige Installationen. Andererseits ist die rein kamerabasierte 2D-Erkennung auf einem handelsüblichen Tablet potenziell anfällig für komplexe Lichtverhältnisse oder optisch nahezu identische Gerichte. Zudem begibt sich das Start-up in eine absolute Abhängigkeit vom Apple-Ökosystem. Das Geschäftsmodell erfordert eine konstante technologische Weiterentwicklung, um die "Churn-Rate" (Kund*innenabwanderung) gering zu halten, da die Wechselkosten für Gastronom*innen bei einer reinen iPad-Lösung verhältnismäßig niedrig sind.

Der Kampf um die Food-Erkennung

Der globale Markt für "AI Food Recognition" und Self-Checkout erlebt derzeit einen massiven Schub. VisioLab hat sich in diesem Umfeld geschickt in lukrativen, hochfrequentierten Nischen positioniert:

- Sport & Entertainment: In den USA stattet VisioLab beispielsweise die Arena des NBA-Teams Orlando Magic mit 43 Systemen aus und deckt damit fast das gesamte Stadion ab. Weitere Kunden sind die NFL-Teams Atlanta Falcons und Carolina Panthers sowie der Fußballclub Inter Miami.

- Bildung & Corporate: Etwa jeder dritte deutsche Uni-Campus nutzt die Technologie über die Studierendenwerke. Hinzu kommen Betriebskantinen von DAX-Konzernen und Kooperationen mit globalen Caterern wie der Compass Group und Aramark.

Allerdings agiert VisioLab nicht konkurrenzlos. Der Wettbewerb ist technologisch divers und hochkapitalisiert. Das US-Start-up Mashgin gilt als einer der härtesten globalen Konkurrenten. Im Gegensatz zu VisioLab setzt Mashgin auf spezielle Kiosk-Terminals mit multiplen 3D-Kameras. Das erhöht zwar die Hardwarekosten und den Installationsaufwand drastisch, verspricht aber eine extrem hohe Erkennungsgenauigkeit selbst bei chaotischen Objektanordnungen. Auch auf dem Heimatmarkt gibt es mit Start-ups wie auvisus ("VisionCheckout") starke Wettbewerber*innen, die ebenfalls KI-Bilderkennung für Betriebsrestaurants und Kantinen anbieten.

Fazit: Hyperwachstum mit Haken

Für die Start-up-Szene liefert VisioLab ein beeindruckendes Beispiel dafür, wie kluges "Go-to-Market"-Design aussieht. Anstatt den kapitalintensiven Weg proprietärer Hardware-Entwicklung zu gehen, nutzt das Team Standard-Consumer-Hardware und fokussiert die gesamte Wertschöpfung auf die smarte KI-Software am Endgerät.

Diese agile Entscheidung ermöglicht das derzeitige Hyperwachstum: Das US-Geschäft steuert bereits rund 50 Prozent zum Umsatz bei und wächst jährlich um über 1.000 Prozent. Mit dem frischen Kapital, dem Ausbau des US-Standorts durch Co-Founder Iwo Gernemann sowie der gezielten Expansion nach Australien, Neuseeland, Österreich, Großbritannien und in die Niederlande stellt VisioLab die Weichen auf globale Skalierung.

Ob das Osnabrücker Start-up langfristig gegen bestens finanzierte US-Giganten und 3D-Kamera-Spezialisten bestehen kann, wird sich an der Robustheit der Software im massenhaften Dauerbetrieb zeigen. Gelingt es VisioLab, durch kontinuierliches KI-Training seinen Genauigkeits- und "Plug-and-Play"-Vorteil auszubauen, hat das Team hervorragende Chancen, den Checkout-Prozess in der Systemgastronomie dauerhaft zu dominieren.

UniteLabs: Der Münchner DeepTech-Herausforderer auf dem Weg zum globalen Labor-Standard?

Das 2024 von Robert Zechlin, Lukas Bromig und Julian Willand gegründete UniteLabs will die Laborautomatisierung von proprietären Hürden befreien. Nach einer Millionenfinanzierung folgte Anfang 2026 der offizielle US-Launch. Wir wollten wissen: Wie realistisch ist die Vision eines herstellerunabhängigen Standards in einem von Hardware-Silos dominierten Markt? Eine Analyse.

Wer heute ein hochmodernes BioTech-Labor betritt, erwartet nahtlos vernetzte HighTech-Forschung. Die Realität sieht oft anders aus: Rund 90 Prozent der Laborgeräte stammen von unterschiedlichen Hersteller*innen und sprechen schlichtweg nicht dieselbe technische Sprache. Um künstliche Intelligenz in der Forschung nutzbar zu machen, müssen hochqualifizierte Wissenschaftler*innen oft als Software-Ingenieur*innen einspringen und mühsam Schnittstellen programmieren. Genau diesen Flaschenhals will das Münchner DeepTech-Start-up UniteLabs beseitigen.

Die Gründer und der Sprung aus München

Hinter UniteLabs stehen Robert Zechlin, Lukas Bromig und Julian Willand. Nach Vorarbeiten ab 2022 wurde das Unternehmen 2024 offiziell gegründet. Das Team vereint interdisziplinäre Expertise aus Chemieingenieurwesen, Wirtschaftsinformatik und Unternehmensstrategie – eine essenzielle Mischung für ein Produkt, das tiefes Prozessverständnis mit modernster Softwarearchitektur verbinden muss.

Dass die Idee einen massiven Schmerzpunkt der Industrie trifft, zeigt die rasante Entwicklung der letzten Monate. Nach einer Pre-Seed-Finanzierungsrunde in Höhe von 2,77 Millionen Euro unter der Führung von NAP (ehemals Cavalry Ventures) im Januar 2025 und der Auszeichnung als „Bestes Münchner Start-up“ beim Munich Startup Award 2025 ist das Unternehmen sichtlich gewachsen. Im ersten Quartal 2026 zählt das Team im Münchner Inkubator Werk1 bereits rund 28 Köpfe.

Doch wie verhindert ein derart rasant wachsendes Team, bei der ständigen Anbindung neuer, exotischer Hardware nicht zu einer hochbezahlten IT-Manufaktur zu verkommen? Schließlich erfordert jedes neue Laborgerät auf dem Markt zunächst einmal Entwicklungsaufwand für den passenden Konnektor.

„Unser Ziel ist nicht, jedes exotische Gerät einzeln ‚irgendwie‘ anzubinden“, stellt Mitgründer Robert Zechlin klar. Vielmehr soll die Integration zu einer wiederholbaren Produktfähigkeit reifen. Statt sich im Klein-Klein der Modellnummern zu verlieren, baue UniteLabs seine Konnektoren entlang grundsätzlicher Geräte-Fähigkeiten. Die puren Herstellerspezifika landen dabei in einer dünnen Adapter-Schicht, während Workflows und Datensemantik konsistent bleiben.

Um die berüchtigte Skalierungsfalle zu umgehen, setzt das Start-up zudem verstärkt auf „Reusable Automation Assets“. „Wir investieren in validierte Workflow-Bausteine, Device-Profile und Test-Suites, mit denen die zweite und dritte Integration deutlich schneller wird als die erste“, betont Zechlin und skizziert damit den Weg zum echten SaaS-Unternehmen. Der Gründer gibt die Richtung selbstbewusst vor: „Die Grenzkosten für das nächste Gerät und den nächsten Standort müssen über Zeit sinken. Unser Endzustand ist ein Ökosystem, in dem Integrationen gemeinsame Infrastruktur sind, nicht Projektgeschäft.“

Vom Prototyp zur Architektur der offenen Labore

Im Februar 2026 hat UniteLabs auf der renommierten Branchenmesse SLAS in Boston den offiziellen US-Launch seines „AI-Ready Lab Automation Systems“ vollzogen. Statt nur isolierte Schnittstellen zu flicken, positioniert sich das Start-up nun mit einer klaren, dreiteiligen Architektur.

Den Kern bildet die Cloud-native „UniteLabs Platform“, die Hardware vernetzt und die Integration von Machine-Learning-Modellen in Echtzeit erlaubt. Ergänzt wird dies durch die lokale Anwendung „GroundControl“ für den Plug-and-Play-Anschluss von Geräten sowie das „UniteLabs SDK“. Letzteres ist ein Python-Werkzeug für Wissenschaftler*innen, um Labor-Workflows komplett als Code zu steuern. Dass diese Theorie praxistauglich ist, beweist das aufstrebende KI-BioTech-Unternehmen Cradle, das die Lücke zwischen Maschinen und digitalen Daten-Lakes intern bereits mit dem Münchner System schließt. Laut UniteLabs soll sich der Labor-Durchsatz für solche KI-getriebenen Forschungsteams durch die Plattform um bis zu das Vierfache steigern lassen.

Ein „Lab-as-Code“-Ansatz via Python mag für entwickleraffine Data Scientists verlockend sein – doch schließt er nicht paradoxerweise die klassischen Biolog*innen aus, für die Code-Workflows oft eine zu steile Lernkurve bedeuten?

„Code ist nicht das Produkt“, kontert Zechlin. Er sei vielmehr eine Schnittstelle, die sowohl Power-User als auch den Laboralltag bedienen müsse. Das SDK richte sich an Teams, die volle Kontrolle über Versionierung und automatisierte Tests verlangen – was im KI-BioTech-Umfeld zunehmend Standard sei. Zechlin räumt jedoch ein, dass das Programmieren nicht jedem liege: „Die meisten wollen zuverlässige Ausführung und klare Transparenz.“

Die Lösung der Münchner: Über die Orchestrierungsschicht und „GroundControl“ werden Workflows paketiert und mit Leitplanken versehen, sodass sie auch für Nicht-Entwickler sicher ausführbar sind. Code bleibt strategisch zwar die „universelle Abstraktion“ über Geräte hinweg, doch das Interface der Zukunft sieht anders aus. Zechlin blickt voraus: „Das User Interface für Wissenschaftler wird zunehmend KI-gesteuert und natürliche Sprache zum primären Interface. UniteLabs dient diesen KI-Applikationen als robuste Surface Area und Source of Truth.“ Die Leitplanke für das Wachstum fasst er in einem Satz zusammen: „Unsere Vision ist: flexibel, wo es Sinn macht, und kompromisslos robust, wo es zählen muss.“

Die Bewährungsprobe auf dem US-Markt

Nach dem Bostoner Launch steht das Start-up nun vor der monumentalen Aufgabe, sich im hochkompetitiven US-Markt zu behaupten. Hier entscheidet sich, ob UniteLabs vom europäischen Hoffnungsträger zum globalen Player reift. Umgeben von gigantischen Investitionen in die KI-Wirkstoffentwicklung reicht es nicht, nur ein weiteres Automatisierungstool zu sein – UniteLabs muss sich als essenzieller „Schaufelhersteller“ für den aktuellen Boom etablieren.

Dabei trifft man auf amerikanische Wettbewerber*innen, die teils mit hunderten Millionen Dollar Venture Capital ausgestattet sind. Wie überlebt ein Münchner Start-up mit einer Pre-Seed-Runde von knapp drei Millionen Euro diese Materialschlacht? Zechlin gibt sich pragmatisch und weicht dem direkten Finanz-Vergleich aus: „Klar: In Infrastrukturmärkten hilft Kapital, aber es ist nicht der entscheidende Hebel.“ Anstatt die Konkurrenz im reinen „Spend“ schlagen zu wollen, baue man auf messbaren Nutzen im Laborbetrieb.

Der Plan scheint aufzugehen: Ein Großteil von Umsatz und Pipeline stammt heute bereits aus den USA, wo UniteLabs Kund*innen an beiden Küsten bedient und mit großen Hardware-Hersteller*innenn kooperiert. „Wir planen für dieses Jahr unseren ersten Big Pharma Roll-out, der sowohl in Europa als auch an Standorten in den USA erfolgen soll“, verrät der Gründer. Um diese Dynamik zu finanzieren, hebe man aktuell eine 9-Millionen-Euro-Seed-Runde für die US-Expansion. Den strukturellen Wettbewerbsvorteil sieht Zechlin in der herstelleragnostischen Verbindung bestehender Geräte: „Statt Rip-and-Replace zu verlangen, werden Workflows schneller produktiv, Daten werden sauber mit Kontext versehen, und Teams können ‚Lab-as-Code‘ wirklich ausrollen.“

Ein strategischer Hebel ist dabei die Zielgruppenansprache. Statt in endlosen Vertriebszyklen mit dem C-Level großer Pharma-Konzerne zu ringen, treibt UniteLabs ein nutzer*innengetriebenes Wachstum voran. Labor-Ingenieur*innen, die durch das Python-SDK wochenlange Schnittstellenprogrammierung einsparen, tragen das System organisch in ihre Unternehmen. Dabei profitiert das Start-up enorm davon, selbst keine Pipettierroboter oder Analysegeräte herzustellen. Als „neutrale Schweiz“ der Labor-Hardware buhlt UniteLabs nicht um lukrative Geräteverkäufe – ein extrem starkes Argument gegen den gefürchteten Vendor-Lock-in amerikanischer Hardware-Giganten.

Stresstest für das Geschäftsmodell und Regularien

Doch die ambitionierte Plattform-Strategie wird kritisch geprüft werden. Das Geschäftsmodell birgt ein ständiges API-Katz-und-Maus-Spiel, da Schnittstellen zu teils stark abgeschirmten Systemen gebaut werden müssen. Wenn etablierte Hersteller*innen ihre Firmware ändern oder Drittanbieter-Zugriffe blockieren, explodieren schnell die Wartungskosten für die Konnektoren.

Bleibt die Frage an den Gründer: Was ist also der Plan B, wenn die Marktführer ihre Schnittstellen per Update plötzlich aktiv verschlüsseln? Reicht der Verweis auf offene Standards wie das SiLA2-Protokoll in der harten Praxis aus?

„Wir gehen davon aus, dass Hersteller ihre Ökosysteme schützen werden. Unsere Strategie darf deshalb nicht auf ‚Goodwill‘ bauen“, gibt sich Zechlin keinen Illusionen hin. Standards wie SiLA2 seien zwar hilfreich gegen Fragmentierung, aber „kein Schutzschild“. Der Ansatz der Münchner ist stattdessen pragmatisch und mehrstufig: Standards nutzen, wo verfügbar, und eigene robuste Adapter bauen, wo nötig. Zudem betreibe man ein Programm mit automatisierten Regressionstests am realen Geräteverhalten, um Fehler durch Updates früh zu erkennen.

Der zweite Baustein der Verteidigung ist kommerzieller Druck. Da Labore zunehmend „Best-of-Breed“-Lösungen kombinieren wollen, würden Hersteller, die Interoperabilität blockieren, zunehmend Deals riskieren. Im Hintergrund investiere man deshalb viel Arbeit in aktiv gepflegte Partnerschaften mit den Produzent*innen. Zechlins Plan B lautet letztlich Resilienz: „Mehrere Integrationspfade, starke Tests, und ein System, das stabil bleibt, auch wenn sich die Oberfläche verändert.“ Er ist sich sicher: „Langfristig wirkt die Ökonomie in Richtung Offenheit.“

Neben blockierender Hardware bleibt die US-Zulassungsbehörde FDA die vielleicht höchste Hürde auf dem Weg in den Enterprise-Markt. Deren strenge Vorgaben zu elektronischen Aufzeichnungen sind der größte Vorbehalt von Pharmaunternehmen gegenüber Cloud-basierten Systemen. Gelingt es UniteLabs, Offenheit mit lückenlosen Audit-Trails zu verknüpfen, könnten sie die berüchtigten Sales-Zyklen drastisch verkürzen.

Doch wie passt maximale Entwickler*innen-Freiheit durch Python-Skripte mit rigider FDA- und GxP-Compliance zusammen? Für Zechlin existiert dieser Widerspruch im Labor-Alltag schlichtweg nicht: „Compliance widerspricht Flexibilität nicht. Was widerspricht, ist unkontrollierte Veränderung.“

Um Big Pharma gerecht zu werden, behandle man hochflexible Workflows wie reguläre Software-Produkte: versioniert, testbar und auditierbar. „Ein Script ist in einem GxP-Kontext kein ‚jeder macht, was er will‘, sondern ein kontrolliertes Artefakt mit definierten Inputs, erwarteten Outputs und einem Validierungsnachweis“, unterstreicht der Mitgründer. Die Plattform trenne Sandbox-Entwicklungen von einer strikt kontrollierten Produktionsebene mit signierten Releases, Environment-Pinning und klarer Datenlineage. Zechlin formuliert einen selbstbewussten Anspruch an die Branche: „Das Labor holt Software-Best-Practices nach. Unser Anspruch ist, ‚compliant by design‘ zur Default-Einstellung für AI-ready Lab Ops zu machen.“

Fazit

UniteLabs hat exzellentes Timing bewiesen. Die BioTech-Branche lechzt nach KI, scheitert aber noch massenhaft an isolierten Daten. Durch das Bereitstellen essenzieller Daten-Infrastruktur haben sich die Münchner in eine starke Ausgangsposition manövriert. Der US-Launch und anstehende Messepräsentationen zeugen vom Anspruch der Gründer. Der ultimative Lackmustest ab 2026 wird jedoch sein, ob die Hardware-Hersteller*innen diesen Wandel dulden – oder den Kampf um ihre lukrativen Software-Margen eröffnen.

Bleibt die Frage nach dem viel zitierten „Endgame“: Baut das Start-up wirklich das globale Betriebssystem für Biotech-Labore, oder macht man sich letztlich nur als hochattraktives Übernahmeziel für Hardware-Giganten hübsch?

Auf diese Entweder-Oder-Frage antwortet Zechlin diplomatisch, aber ambitioniert: „Unsere Vision ist, die neutrale Betriebsschicht für moderne Labore zu werden, weil die Branche einen herstellerunabhängigen Standard braucht, nicht noch ein weiteres Einzellösungstool.“ Gleichzeitig sei man Realist: Infrastruktur zähle nur, wenn sie im Alltag zuverlässig genutzt werde und verlässliche, strukturierte Daten für KI liefere.

Sollte das gelingen, hält sich UniteLabs alle Optionen offen – von der unabhängigen Kategorie-Definition über strategische Partnerschaften bis hin zum Exit. Doch auf einen schnellen Verkauf schiele man nicht, verspricht Zechlin: „Wir bauen nicht für eine Übernahme. Wir bauen so, dass der Markt die Plattform ernst nehmen muss.“ Und am Ende solle ohnehin der/die Kund*in profitieren: „Weniger Silos, schnellere Science, und ein Ökosystem, in dem Innovation nicht an proprietären Schnittstellen hängen bleibt.“

Openlaw sichert sich 3,3 Mio. US-Dollar für digitale Rechtsinfrastruktur

3,3 Mio. USD gegen Europas Bürokratie: Das LegalTech-Start-up Openlaw automatisiert mit beglaubigt.de den Gründungsprozess als digitale Infrastruktur.

Die europäische Plattform für digitale Rechts- und Notarinfrastruktur Openlaw hat eine Seed-Finanzierungsrunde in Höhe von 3,3 Millionen US-Dollar abgeschlossen. Das 2024 gegründete Münchner LegalTech-Start-up, das im Heimatmarkt vor allem unter der Marke beglaubigt.de agiert, will mit dem frischen Kapital den bürokratischen Gründungs- und Verwaltungsprozess in Europa radikal vereinfachen. Zu den Geldgebern zählen unter anderem YouTube-Mitgründer Jawed Karim über Y Ventures, Moonfire Ventures (gegründet von Atomico-Cofounder Mattias Ljungman), Zeno Ventures, Combination VC, Orange Collective sowie diverse Business Angels und Alumni des Y Combinators.

Von der Unicorn-Skalierung zur Infrastruktur: Die Gründerhistorie

Hinter Openlaw stehen zwei Köpfe mit beachtlicher Start-up-Vita, die den Schmerz der europäischen Bürokratie aus eigenen Gründungs- und Skalierungsphasen kennen:

Alexander Sporenberg (CEO): Er gehörte zum Gründungsteam der Razor Group, einem E-Commerce-Aggregator, der in nur 15 Monaten zum Unicorn mit einer Bewertung von 1,7 Milliarden US-Dollar aufstieg. Bei hunderten M&A-Deals erlebte Sporenberg Notartermine und Registerprozesse als massives Nadelöhr für das Unternehmenswachstum.

Felix Gerlach (CPO): Nach seiner Zeit im Ökosystem von Rocket Internet gründete Gerlach die Identity-Verification-Plattform Passbase. Nachdem internationale US-Investoren einstiegen, wurde das Unternehmen 2023 an Parallel Markets verkauft. Seine Expertise im Aufbau skalierbarer Infrastrukturen fließt nun in die Produktentwicklung bei Openlaw.

Mit diesem Background schaffte es das Duo in das hochkompetitive Programm des kalifornischen Y Combinators (F24 Batch). Durch die Zeit in San Francisco verfestigte sich die Vision, die technologische Lücke zwischen dem US-Markt, wo Gründungen teils in nur 24 Stunden abgeschlossen sind, und dem europäischen Flickenteppich aus 27 Rechtssystemen und über 60 Gesellschaftsformen zu schließen.

API-First statt Papierkrieg

Das Kernversprechen von beglaubigt.de ist eine drastische Effizienzsteigerung durch die Digitalisierung des administrativen Überbaus. Während eine reguläre GmbH-Gründung in Deutschland meist sechs bis acht Wochen in Anspruch nimmt, will Openlaw diesen Prozess laut eigenen Angaben auf bis zu drei Tage drücken.

Dabei agiert das Start-up explizit nicht als Ersatz für bestehende Institutionen. Vielmehr fungiert das Modell als prozessoptimierende Schicht für Gründer*innen:

Die Plattform übernimmt die Administration, die Terminkoordination, die Dokumentenvorbereitung sowie die Registeranmeldungen. Dafür arbeitet beglaubigt.de regelmäßig mit einem Netzwerk aus rund 300 Notariaten zusammen. Die originär hoheitlichen Aufgaben – die juristische Beratung, rechtliche Belehrung und die eigentliche Beurkundung – verbleiben zwingend bei den kooperierenden Notariaten.

Ein wesentlicher USP und Skalierungshebel ist die technologische Anbindung an Drittanbieter. Openlaw betreibt eine vollautomatisierte "Incorporation API". Diese erlaubt es Partnern wie den Neobanken Qonto und Holvi oder dem Buchhaltungstool Sevdesk, den gesamten Gründungsprozess nativ in ihre eigenen Workflows zu integrieren. Ein(e) Kund*in kann so beispielsweise im Rahmen einer Kontoeröffnung bei Qonto direkt die Unternehmensgründung mit anstoßen, ohne die Plattform wechseln zu müssen. Bis heute hat das rund 20-köpfige Team nach eigenen Unternehmensangaben über 25.000 Kund*innen über die Plattform betreut.

Marktumfeld und Wettbewerb

Dass eine Beschleunigung im Ökosystem not tut, ist unumstritten. Laut dem DIHK-Report 2025 sind beinahe 60 Prozent der Gründer*innen mit dem Standort Deutschland unzufrieden; drei Viertel fordern deutlich schnellere und einfachere Regularien. Die Politik versucht zwar auf europäischer Ebene, mit Vorstößen wie der EU Inc. die Entbürokratisierung voranzutreiben. Doch was nach der eigentlichen Gründung folgt – wie Steuerregistrierung, Handelsregister, Geschäftsadresse und laufende Administration – bleibt hochkomplex und national geregelt. Zudem muss in Kernmärkten wie Deutschland, Spanien und Frankreich die Unternehmensgründung notariell beurkundet werden.

In diesem Setup muss sich das Geschäftsmodell von Openlaw bewähren und kritischen Fragen stellen:

- Der harte Flaschenhals des Notarmonopols: So reibungslos Openlaw den Prozess per Software orchestriert, am Ende bleibt das Tempo durch die Kapazitäten der angeschlossenen Notariate und Amtsgerichte limitiert. Openlaw optimiert den Weg zum und vom Notariat sowie den administrativen Overhead, kann die Institution selbst aufgrund gesetzlicher Vorgaben aber nicht disruptieren.

- Dicht besiedelter Wettbewerb: Der Markt für „Gründung als Service“ in Deutschland ist umkämpft. Etablierte Player wie firma.de, Rechtstech-Kanzleien (z.B. Recht24/7) oder hochspezialisierte Anbieter wie RIDE (Fokus auf vermögensverwaltende GmbHs und Holding-Strukturen) bedienen die Sehnsucht nach administrativen Abkürzungen schon länger.

- Der strategische Vorteil durch B2B: Der entscheidende Differenzierungsfaktor von Openlaw scheint weniger das Endkund*innengeschäft zu sein, sondern der radikale API-First-Ansatz. Gelingt es, die eigene Schnittstelle als unsichtbare Standard-Infrastruktur in europäische FinTech-Lösungen und Banking-Apps einzuweben, profitiert Openlaw von massiven Lock-in-Effekten und senkt gleichzeitig die Customer Acquisition Costs (CAC), da Partner wie Qonto oder Sevdesk den Traffic liefern.

Ausblick

Mit dem frischen Kapital will Openlaw das Produktangebot seiner deutschen Marke gezielt ausbauen. Neben Standardgründungen (GmbH, UG, GbR) und steueroptimierten Holding-Strukturen sollen künftig auch weitere Registerprozesse sowie die laufende Buchführung vollständig über die Plattform abgewickelt werden. Das langfristige Ziel bleibt dabei die Expansion in weitere europäische Märkte, um Gründer*innen eine grenzübergreifende digitale Infrastruktur für den laufenden Betrieb zu bieten.

Strategischer Exit: food42morrow übergibt seine Getränkemarke JUMA an die Berentzen-Gruppe

Die Konsolidierung im Markt für funktionale Getränke setzt sich fort: die 2022 gegründete food42morrow GmbH übergibt ihre Marke JUMA im Rahmen eines strategischen Exits an die Vivaris Getränke GmbH & Co. KG, eine Tochtergesellschaft der börsennotierten Berentzen-Gruppe Aktiengesellschaft. Ab Mai 2026 soll die großflächige Skalierung unter der Flagge von Vivaris als JUMA Recharge+ erfolgen.

Die food42morrow GmbH wurde 2022 in Frankfurt am Main mit dem Ziel gegründet, Marktlücken im Bereich Functional Food durch wissenschaftlich fundierte und trendorientierte Konzepte zu schließen. Die Gründer Raoul Kammann, Max Kammann und Carlos Lopez Granado entwickelten mit JUMA eine Antwort auf die steigende Nachfrage nach natürlichen Wachmachern.

Das Kernprodukt RECHARGE+ ist ein teebasierter Hydration Drink, der Elektrolyte, Vitamine und natürliches Koffein (u. a. aus Guayusa) kombiniert. Der Fokus liegt hierbei auf einer Funktionalität ohne Zuckerzusatz, die speziell auf die Bedürfnisse einer urbanen, aktiven Zielgruppe zugeschnitten ist. Bereits 2025 konnte das Start-up die Marktfähigkeit durch erste Listungen im deutschen Lebensmitteleinzelhandel (LEH) nachweisen.

Packaging-Innovation als strategischer Hebel

Ein wesentliches Alleinstellungsmerkmal, das den Exit maßgeblich begünstigt haben dürfte, ist das innovative Gebinde. food42morrow brachte als erstes Unternehmen in Deutschland eine wiederverschließbare Aluminiumflasche mit Schraubverschluss in dieser Kategorie auf den Markt. Diese Verpackung kombiniert die hohe Recyclingquote von Aluminium mit der Flexibilität einer Flasche. Für etablierte Konzerne wie die Berentzen-Gruppe stellt eine solche bereits validierte „Hardware-Innovation“ einen hohen Wert dar, da sie das Risiko bei der Markteinführung neuer Kategorien senkt.

Einordnung: Die „Evolve 2030“-Strategie

Der Zukauf durch die Berentzen-Gruppe ist kein Zufall, sondern Teil einer breiteren Branchenbewegung. Mit der Strategie BERENTZEN EVOLVE 2030 reagiert der Konzern auf den rückläufigen Spirituosenkonsum und investiert massiv in das Segment der alkoholfreien Getränke (AfG). JUMA fungiert hierbei als Portfolio-Ergänzung im margenstarken Premium-Bereich der funktionalen Drinks. Ähnliche Strategien verfolgten zuletzt auch Akteure wie Eckes-Granini oder die Paulaner-Gruppe bei der Integration agiler Innovationsmarken.

Key Learnings für Gründer*innen

Aus dem Case food42morrow lassen sich drei zentrale Erkenntnisse für die Skalierung von Konsumgüter-Start-ups ableiten:

- USP durch Packaging: In einem gesättigten Markt reicht ein guter Inhalt oft nicht aus. Eine technologische oder funktionale Innovation bei der Verpackung kann der entscheidende Türöffner für den LEH und für Akquisitionsgespräche sein.

- Validierung vor Skalierung: Der Exit erfolgte erst, nachdem die Marktfähigkeit (Proof of Market) durch erste Listungen 2025 bewiesen war. Große Player kaufen bevorzugt Marken, die ihre „Kinderkrankheiten“ bereits überwunden haben.

- Positionierung als „Brückenbauer“: food42morrow hat sich erfolgreich als Bindeglied zwischen Start-up-Agilität und industrieller Skalierung positioniert. Dies ermöglicht es den Gründern, sich auf ihre Kernkompetenz – die Produktentwicklung – zu konzentrieren, während die massive Distribution durch die Strukturen eines Konzerns erfolgt.

Was kommt nach JUMA?

Mit der Übergabe der Marke an Vivaris stellt food42morrow seine Kompetenz als Innovationstaktgeber unter Beweis. Bleibt die spannende Frage, welche Trends das Frankfurter Team als Nächstes identifiziert.

Steckrübe statt Schwein: Verrano sichert sich hohe sechsstellige Finanzierung für die „Clean Label“-Revolution

Das 2023 gegründete Frankfurter Start-up Verrano hat ein neuartiges Verfahren entwickelt, das regionales Wurzelgemüse durch Reifung und Räucherung in eine pflanzliche Alternative zu Wurstersatzprodukten verwandelt.

Hinter Verrano, das Anfang 2023 in Frankurt/Main gegründet wurde, steht ein branchenerfahrenes, dreiköpfiges Gründerteam rund um Geschäftsführer Manuel Siskowski. Die Idee reifte jedoch schon lange vor der formellen Gründung. Getreu dem internen Motto „natürlich köstlich“ experimentierten die Gründer – zu denen auch Maximilian Bubenheim mit seiner Erfahrung aus der Sternegastronomie sowie Felix Linnenschmidt gehören – mehrere Jahre mit Wurzelgemüse.

Dabei wendeten sie ein Verfahren an, das in ähnlicher Form beim Reifen von klassischem Schinken zum Einsatz kommt. Nach ersten erfolgreichen Testläufen im regionalen Bio-Handel konnten bald die ersten Kund*innen mit Mengen aus der in Biebertal bei Gießen installierten Pilotanlage beliefert werden.

Handwerkstradition trifft Gemüse

Anstatt klassische Fleischersatzprodukte nachzuahmen, setzt Verrano auf die handwerkliche Veredelung. Regionale Rohstoffe wie Steckrübe, Sellerie und Rote Beete werden einem speziellen Fermentations- und Räucherverfahren unterzogen. Das Endprodukt zeichnet sich durch einen enormen Gemüseanteil von rund 95 Prozent aus und kommt mit nur wenigen Zutaten aus, ohne künstliche Zusatzstoffe zu verwenden. Das Ergebnis soll laut Unternehmensangaben in seiner Textur und dem Geschmack an hochwertige Fleischprodukte wie Schinken erinnern. Die kulinarischen Kreationen werden bereits als dünner Aufschnitt, im Würfelmix oder am Stück in den Markt eingeführt und eignen sich flexibel als Brotbelag, zum Kochen oder für Snackplatten. Die Innovationskraft dieses Ansatzes wurde kürzlich von PETA mit dem „VEGAN AWARD 2026“ in der Kategorie „beste vegane Innovation“ ausgezeichnet.

Eine neue Kategorie jenseits der Imitation

Der Markt für pflanzliche Alternativen konsolidiert sich aktuell, während die Lebensmittelbranche verstärkt nach innovativen pflanzlichen Produkten sucht, die neue Geschmackserlebnisse erzeugen. Hier positioniert sich Verrano in der stark wachsenden Nische der „Clean Label“-Produkte. Direkte Wettbewerber*innen mit einem identischen Ansatz sind rar, da die meisten großen Player*innen weiterhin auf Extrusionsverfahren von Proteinisolaten setzen. Verrano erschafft vielmehr eine neue Kategorie: Eine pflanzliche Feinkost, die das Naturprodukt Gemüse transformiert. Dass diese Nische massentauglich ist, bewies das Start-up jüngst im Veganuary durch aufmerksamkeitsstarke Listungen deutschlandweit in den Bordbistros der Deutschen Bahn.

Die Herausforderungen am Markt

Trotz der vielversprechenden Traction und der Skalierbarkeit, die bereits mit der Pilotanlage bewiesen wurde, steht das Start-up vor großen operativen Herausforderungen, um den Start im breiten Handel zu ermöglichen. Ein Reifeprozess, der Wochen in Anspruch nimmt, bindet extrem viel Working Capital, da enorme Mengen vorproduziert und gelagert werden müssen. Zudem verhält sich Gemüse im Reifeprozess mikrobiologisch grundlegend anders als Fleisch. Die Qualitätssicherung erfordert hochpräzise Produktionsumgebungen, um die Haltbarkeit bei größeren Mengen zu garantieren. Letztlich bedarf es auch starker Aufklärungsarbeit und forcierter Vertriebsaktivitäten am Konsument*innen, um Wurzelgemüse dauerhaft als Premium-Feinkostprodukt zu etablieren.

Reale Skalierung statt VC-Hype

Genau bei diesen Herausforderungen zeigt sich die strategische Passung der aktuellen Finanzierungsrunde. Dass Verrano die bestehenden Produktionskapazitäten massiv ausweiten muss, um die ansteigende Nachfrage zu bedienen, ist der klassische Flaschenhals von Food-Start-ups. Der überwiegende Teil der eingeworbenen Mittel fließt in genau diesen Zweck. Dass die Finanzierungsrunde dabei, wie StartingUp aus Branchenkreisen erfuhr, im hohen sechsstelligen Bereich liegt, beweist die Kapitaleffizienz des Unternehmens. Anstatt reines Risikokapital in teure Eigenentwicklungen zu pumpen, setzt Verrano auf „Smart Money“.

Mit dem Maschinenbauer Weber Food Technology und der Wurst- und Schinkenmanufaktur Bedford holen sie sich zwei strategische Industrie-Schwergewichte an Bord. Verrano profitiert hier direkt von jahrzehntelanger Expertise in der mikrobiologischen Reifung sowie im industriellen High-Tech-Slicing. Zusammen mit der BMH, die als VC-Tochter der Helaba aktuell Fonds mit einem Volumen von 450 Millionen Euro verwaltet, hat das Start-up starke Partner für die anstehende Geschäftsentwicklung gewonnen. Dieses Konsortium bietet das Rüstzeug, um die Nische der veganen Boutiquen zu verlassen und den Lebensmitteleinzelhandel zu adressieren.

Griff nach den Sternen: Lieferando- und Tier-Mitgründer sammelt 5 Mio. Euro für Solarenergie aus dem All

Das europäische Start-up TerraSpark will sauberen Strom per Funk aus dem Orbit zur Erde schicken. Mit dabei: der Deutsche Matthias Laug, Mitgründer von Lieferando und Tier Mobility, sowie deutsche Investoren. Wir wollten wissen: Wie realistisch ist das ehrgeizige Vorhaben der Tech- und Raumfahrt-Veteranen? Eine Einordnung.

Europas Energieinfrastruktur stößt zunehmend an ihre Grenzen. Während die Internationale Energieagentur (IEA) prognostiziert, dass sich der Strombedarf von Rechenzentren bis 2030 mehr als verdoppeln wird, zeigten großflächige Stromausfälle in Spanien und Portugal zuletzt die Schwächen der heutigen Energiesysteme auf.

Eine radikale Lösung für dieses drängende Problem verspricht nun das 2025 in Luxemburg gegründete Start-up TerraSpark. Das junge Unternehmen hat eine Pre-Seed-Finanzierungsrunde in Höhe von über fünf Millionen Euro erfolgreich abgeschlossen. Zu den Geldgebern zählen neben der Pariser Gesellschaft Daphni und dem Tech-Investor Sake Bosch auch die Angel-Investoren-Allianz better ventures und die Hans(wo)men Group. Ihr gemeinsames Ziel: Weltraumgestützte Solarenergie kommerziell nutzbar zu machen.

Prominente deutsche Wurzeln in einem hochkomplexen Hardware-Projekt

Dass dieses Vorhaben für die hiesige Gründerszene von besonderem Interesse ist, liegt maßgeblich an der personellen Aufstellung. Hinter TerraSpark steht ein Gründertrio, das eine seltene Kombination aus europäischer Raumfahrtexpertise und massiver Skalierungserfahrung vereint. Aus deutscher Sicht sticht hierbei besonders Chief Operating Officer Matthias Laug hervor. Als Mitgründer von Lieferando und Tier Mobility bringt er tiefe Erfahrung im Aufbau und in der Skalierung großer europäischer Plattformunternehmen in das komplexe Projekt ein.

Geführt wird das Team von CEO Jasper Deprez, einem Seriengründer, der zuvor die globale HR-Tech-Plattform Tradler aufbaute. Die zwingend notwendige Raumfahrt-Expertise liefert Chief Technology Officer Dr. Sanjay Vijendran: Er verantwortete bei der Europäischen Weltraumorganisation (ESA) bereits das Solaris-Programm zur weltraumgestützten Solarenergie und war an der Mars Sample Return Mission beteiligt. Auch auf Investor*innenseite ist das deutsche Vertrauen in das Team groß. Tina Dreimann, Gründerin und Geschäftsführerin von better ventures, lobt genau diese Mischung aus europäischer Raumfahrtkompetenz und der Erfahrung, Technologie wirklich zu skalieren.

Erst die Erde, dann das All

Die Vision des Trios ist gewaltig: Solarenergie soll im Weltraum eingefangen und per Funkfrequenz sicher zur Erde übertragen werden. Das Konzept ist in der Theorie bereits seit den 1970er Jahren bekannt, doch erst heute machen sinkende Startkosten sowie technologische Fortschritte in der Satellitenfertigung und Orbitrobotik die Umsetzung wirtschaftlich tragfähig.

Anstatt jedoch das immense Risiko einzugehen und sofort mit gigantischen Systemen im All zu beginnen, wählt TerraSpark bewusst einen schrittweisen Kommerzialisierungs-Ansatz. Das Startup startet auf der Erde mit der Kommerzialisierung funkfrequenzbasierter drahtloser Energieübertragung für industrielle Anwendungsfälle. Mit diesem pragmatischen Schritt sollen Sicherheit, Effizienz und regulatorische Kompatibilität im kleinen Maßstab demonstriert werden, bevor das System in den Orbit skaliert wird. Ein hochrelevanter Markt für diese erste Phase sind netzferne Regionen, die bislang auf Dieselgeneratoren angewiesen sind. Dort liegen die Stromkosten häufig bei etwa 0,70 bis 1,50 Euro pro Kilowattstunde – ein starkes Preissignal, das technologische Alternativen rasch wirtschaftlich attraktiv machen kann.

Um diesen Markt zu erschließen, bereitet das Unternehmen in den kommenden Monaten erste Pilotanwendungen vor, darunter die drahtlose Energieversorgung eines Live-Events. Auch die Roadmap für den Weg ins All steht: Ein erster orbitaler Technologie-Demonstrator ist für das Jahr 2027 geplant, die erste echte Weltraum-zu-Erde-Energieübertragung wird für 2028 anvisiert.

Markt, Wettbewerb & Machbarkeit

Obwohl die Physik hinter der funkfrequenzbasierten Energieübertragung laut CTO Sanjay Vijendran seit Jahrzehnten validiert ist, bleibt die weltraumgestützte Solarenergie ein extrem komplexes Unterfangen. TerraSpark ist auf diesem kapitalintensiven Spielfeld nicht allein. Neben Start-ups wie Virtus Solis aus den USA oder dem neuseeländisch-deutschen Unternehmen Emrod haben auch etablierte Luft- und Raumfahrtgiganten wie Airbus das enorme wirtschaftliche Potenzial längst erkannt und treiben eigene Forschungsprogramme voran.

Kritisch zu hinterfragen bleibt bei all diesen Vorhaben die technische Effizienz der Energieübertragung über gewaltige Distanzen bis hinunter zur Erde. Die Errichtung großflächiger Solarpaneele im Weltall erfordert trotz signifikant sinkender Frachtpreise weiterhin immense Vorabinvestitionen und unzählige Raketenstarts. Zudem muss der internationale regulatorische Rahmen für das Richten von hochkonzentrierten Funkwellen aus dem All auf irdische Empfangsstationen erst noch global abgestimmt werden.

Fazit

Der „Earth-first“-Ansatz von TerraSpark ist ein äußerst kluger, unternehmerischer Schachzug. Er mildert das finanzielle Risiko für die Seed-Investoren ab, demonstriert Technologie greifbar im Kleinen und könnte frühe B2B-Umsätze generieren, lange bevor die erste Hardware ins All fliegt. Dennoch bleibt der Meilenstein-Plan enorm ambitioniert. Matthias Laug und seine Mitstreiter*innen haben in der Vergangenheit zwar eindrucksvoll bewiesen, dass sie digitale und urbane Geschäftsmodelle massiv skalieren können. Der Schritt vom E-Scooter-Verleih zur interplanetaren Energie-Infrastruktur erfordert in den kommenden Jahren jedoch eine völlig neue Dimension der Exekution – und noch deutlich tiefere Taschen der Investor*innen.

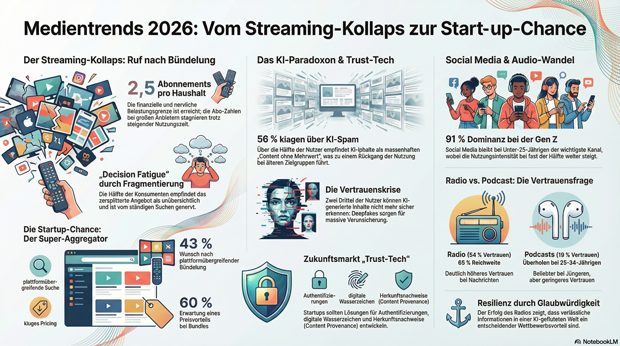

Mediennutzung 2026: Zwischen KI-Frust, Abo-Müdigkeit und neuen Chancen für Start-ups

Die Deutschen experimentieren so intensiv wie nie mit künstlicher Intelligenz (KI), sind aber zunehmend genervt von Deepfakes und „Content ohne Mehrwert“. Gleichzeitig sehnt sich der überhitzte Streaming-Markt nach einer drastischen Konsolidierung. Die aktuelle Deloitte-Studie „Media Consumer Trends 2026“ liefert nicht nur Bestandsaufnahmen, sondern zeigt deutlich, wo für Gründer*innen und Tech-Unternehmen jetzt die wahren Opportunitäten liegen.