Aktuelle Events

Blockchain – eine ethische Revolution?

Durch die technisch geprägten Blockchain-Anwendungen tritt der Faktor Mensch zunehmend in den Hintergrund. Hier stellt sich die Frage: Wie kann er (dennoch) von der Blockchain-Technologie profitieren?

Die Blockchain-Technologie ist nun seit einigen Jahren ein Begriff, auch dank einer ihrer Anwendungsformen, dem Bitcoin. Etliche weitere Anwendungen stehen kurz davor, dem Massenmarkt zugänglich gemacht zu werden. Gerade deshalb scheint eine Diskussion über ethische Aspekte mehr als notwendig, um diesen Übergang möglichst gut zu bestreiten. Die Frage ist daher, inwieweit der Mensch durch diese technisch geprägten Anwendungen in den Hintergrund tritt und wie er dennoch von der Blockchain-Technologie profitieren kann.

Alle wissen alles

Mit den Anwendungen der Blockchain betreten wir ein völlig neues, ethisches Terrain. In der Geschichte der Menschheit war es stets so, dass Wissen Macht ist. Dies ist auch heute noch so. Deshalb versuchen gewisse Interessensgemeinschaften Wissen für den eigenen Vorteil zu verheimlichen oder zu verschleiern. Mit der Blockchain funktioniert dies eben nicht mehr, da alle Teilnehmer über den anderen Bescheid wissen und dies völlig anonym. Sieh dir die blockchainbasierte Kryptowährung Bitcoin an: Jeder weiß, wie viel Konten es gibt und wie viele Bitcoin sich darauf tummeln, dennoch weiß man nicht, wem diese Konten gehören. Jede Transaktion ist nachverfolgbar und dennoch anonym. Anonymität und Transparenz in einer noch nie dagewesenen Kombination ist etwas, das es in der Menschheitsgeschichte bis dato noch nicht gegeben hat und stellt deshalb eine fantastische Möglichkeit dar, eine neue Form der Ethik zu etablieren.

Abstrakte Algorithmen mit konkretem Nutzen

Um die technischen Aspekte der neuen Technologie verstehen zu können, müsste man Mathematiker sein; um deren Auswirkungen zu erkennen, müssen wir nur unseren gesunden Hausverstand einschalten. Die Blockchain ermöglicht vor allem eines: gnadenlose Transparenz. Weshalb „gnadenlos“? Genau aus den oben angesprochenen ethischen und moralischen Aspekten. Je nachdem, was geplant wird, kann Transparenz ein großes Problem für die unethisch agierende Partei bedeuten. Wahlen, die eigentlich getürkt werden sollen, können über die Blockchain abgewickelt und durch die Transparenz eben nicht mehr manipuliert werden. Jede abgegebene Stimme ist einsichtig. Nehmen wir das Beispiel einer Banküberweisung: Es kann nicht mehr zu Bankenkrisen kommen, wenn mit der Blockchain gearbeitet wird, da stets einsichtig ist, wie viel „Wert“ tatsächlich vorhanden ist. Nur diese beiden Aspekte betrachtend ist die Blockchain absolut ethisch und bedeutet, moralisch gesehen, einen enormen Aufschwung für den „normalen“ Bürger.

Blockchain ist die pure Wahrheit

Man kann, egal in welchem Bereich, nur unethische Dinge durchführen, wenn niemand davon weiß. Genau hier hakt die Blockchain ein, indem sie alles sichtbar macht. Nichts wird jemals vergessen, weil sie alles abspeichert. Das Schöne dabei: Es wird keine zentrale, unabhängige Instanz benötigt, um dies zu bewerkstelligen. Das Einzige, was benötigt wird, ist eine Community. Ohne Community gibt es auch keine Blockchain. Sie stellt eine völlig neue Form der Demokratie dar, an der jeder partizipieren und durch die jeder profitieren kann. Es kommt zu einer zunehmenden Gleichverteilung der Macht, was derzeitigen Machtinhabern natürlich nicht passen dürfte. Der Beginn wurde jedenfalls gemacht.

Unternehmensethik

Wie bereits oben beschrieben wurde, ist Wissen Macht. Ergänzend muss hinzugefügt werden, dass Image und Wissen Macht ist, vor allem wirtschaftlich. Stellen Sie sich vor, dass Sie über die finanzielle Situation Ihres Kooperationspartners bescheid wissen. Auch dies ermöglicht die Blockchain, da Sie im Grunde nichts anderes als ein Informationsspeicher ist. Es kann nun nicht mehr passieren, dass Sie blindlings in ein anderes Unternehmen investieren oder mit ihm Geschäfte machen, ohne über die tatsächliche wirtschaftliche Situation Bescheid zu wissen. Unternehmen der Zukunft werden alles tun, um sich selbst eine solide, wirtschaftliche Basis aufzubauen, da man nur mehr mit solchen Unternehmen zusammenarbeiten möchte. Es wird nichts mehr nützen, lediglich Hochglanzbroschüren zu verteilen, sondern nachhaltige und ehrliche Arbeit wird wieder in den Vordergrund rücken. Offen, ehrlich und fair.

Fazit

Wir stehen ganz am Beginn einer ethischen Revolution aller Bereiche unseres Lebens. Niemand weiß, wie dieser Prozess weitergeht, geschweige denn, wie er endet. Was wir jedoch wissen ist, dass wir mit der Blockchain das erste Mal in der Geschichte der Menschheit ein Werkzeug an die Hand bekommen haben, welches absolute Freiheit mit Transparenz und Sicherheit kombiniert. Seien wir gespannt auf die Zukunft.

Über den Autor: Als erfolgreicher FINTECH-Entrepreneur und Blockchain-Experte führt Alex Reinhardt zukunftsweisende Technologien Richtung Massentauglichkeit.

Diese Artikel könnten Sie auch interessieren:

Stallgrün: Mit Hightech-Kräutern gegen den Agrar-Strukturwandel

Leere Ställe als Chance: das 2023 von Judith Ryll und Thorsten Lansmann-Niehaus gegründete Stallgrün nutzt Bestandsbau für Indoor Farming. Wir checken das Modell hinter der aktuellen 125.000-€-DBU-Förderung.

Der Strukturwandel in der deutschen Landwirtschaft ist unaufhaltsam: Allein zwischen 2013 und 2023 ging die Zahl der hiesigen Betriebe mit Schweinehaltung um 44 Prozent zurück, wie Zahlen des Bundesministeriums für Ernährung und Landwirtschaft (BMEL) belegen. Jedes Jahr geben Landwirt*innen auf. Zurück bleiben leere Ställe – und Landwirtschaftsbetriebe auf der Suche nach neuen finanziellen Perspektiven.

Das 2023 in Münster gegründete Start-up Stallgrün will aus diesen „Stranded Assets“ einen lukrativen Zukunftsmarkt formen: Indoor Farming im ehemaligen Schweinestall. Die Deutsche Bundesstiftung Umwelt (DBU) unterstützt das Projekt aktuell mit 125.000 Euro im Rahmen ihrer Green Startup-Förderung. Wir wollten wissen: Wie tragfähig ist das Modell jenseits der Fördergelder wirklich?

Die Köpfe hinter der Idee & die Historie

Hinter Stallgrün stehen die Gründer Judith Ryll und Thorsten Lansmann-Niehaus. Ryll bringt als Biowissenschaftlerin tiefe Expertise in der Pflanzenbiologie mit, während Lansmann-Niehaus – der bezeichnenderweise selbst auf einem Schweinemastbetrieb aufwuchs – die kaufmännische Führung übernimmt. Gefördert durch regionale Inkubatoren wie das Seedhouse, hat das Duo den technologischen Machbarkeitsnachweis bereits erbracht: In den vergangenen zwei Jahren wurde das Konzept auf einer Pilotfarm erfolgreich entwickelt.

Das Geschäftsmodell: Mehr als nur Hardware

Die Grundprämisse ist so simpel wie pragmatisch: Ehemalige Schweineställe sind in der Regel massiv gebaut sowie gut isoliert und bieten damit architektonisch ideale Bedingungen für den ganzjährigen Anbau von regionalen Kräutern und Gemüse. Stallgrün positioniert sich als B2B-Technologie- und Service-Provider für Höfe im Wandel und will deutschlandweit agieren. Das System fußt auf drei wesentlichen Säulen:

- Automatisierte Anlagentechnik: Als Kernprodukt hat das Start-up während der DBU-Förderung eine Anlage entwickelt, welche die Bewässerung, Düngung, Belichtung und Klimatisierung automatisiert steuert.

- Datengetriebene Agrar-Software: Ergänzend liefert das Team spezifische Anbauprotokolle für die teilnehmenden Betriebe. Für geeignete Kulturen wurde der optimale Einsatz von Parametern wie Saatgut, Erde, Dünger, Licht und Bewässerungszyklen definiert.

- B2B-Ökosystem: Um die Einstiegshürde zu minimieren, hat Stallgrün einen Materialhandel für passendes Anbaumaterial aus einer Hand aufgebaut und bietet rechtliche Hilfen bei der Verwaltung an. Zudem unterstützt das Start-up beim Aufbau der Vermarktung.

Stallgrün versteht sich dabei nicht als Feind der traditionellen Landwirtschaft. Laut Lansmann-Niehaus ist Indoor Farming kein Ersatz für den etablierten Freiland- oder Gewächshausanbau, sondern eine wetter- und klimaunabhängige Ergänzung.

Die Vision: Produkte sollen ganzjährig regional verfügbar gemacht werden. Die vermehrte Nutzung regionaler Lebensmittel anstelle von Importen reduziere zudem den Transportaufwand und die daraus entstehenden Emissionen.

Kritische Markteinordnung

Der Markt für Vertical- und Indoor-Farming ist ein hartes Pflaster. Prominente Branchenvorreiter wie das ehemals hochgelobte Berliner Start-up Infarm haben in der Vergangenheit massiv Risikokapital verbrannt, weil die schiere Skalierung von energieintensiven Hightech-Farmen in urbanen Ballungsräumen betriebswirtschaftlich oft zum Scheitern verurteilt war.

Hier liegt der geniale, aber auch kritische Hebel von Stallgrün: Anstatt teure Gewerbeimmobilien anzumieten, nutzt das Team bestehende, ländliche Infrastruktur. Das verhindert eine zusätzliche Versiegelung von Flächen, was auch DBU-Generalsekretär Alexander Bonde als zentralen ökologischen Faktor hervorhebt. Ein weiterer Wettbewerbsvorteil: Viele Höfe verfügen bereits über großflächige Photovoltaikanlagen auf ihren Stalldächern. Damit lässt sich der enorme Strombedarf für die Belichtung und Klimatisierung teilweise direkt durch eigenen, günstigen Sonnenstrom abdecken.

Dennoch bleiben aus unserer Sicht drei gravierende Hürden für das Geschäftsmodell:

- CAPEX-Intensität: Die Umrüstung eines leeren Stalls in eine funktionsfähige Hightech-Anlage ist extrem kapitalintensiv. Es bleibt fraglich, wie Landwirte, die gerade aus der unprofitablen Schweinehaltung ausgestiegen sind, das nötige Investitionskapital für diesen Hardware-Neustart bei ihren Banken abrufen können.

- Radikaler Kulturwandel: Einen traditionellen Schweinemäster in einen agilen, datengetriebenen Indoor-Kräuterproduzenten zu transformieren, erfordert enormen Beratungs- und Change-Management-Aufwand seitens Stallgrün.

- Wettbewerb & Margendruck: Die teilnehmenden Bauern und Bäuerinnen kämpfen letztlich gegen die extrem knappen Margen des Lebensmitteleinzelhandels.

Unser Fazit

Stallgrün liefert einen erfrischend bodenständigen „Hardware-meets-Agrar“-Ansatz in einem Tech-Segment, das lange Zeit von utopischen, rein urbanen Vertical-Farming-Träumereien dominiert wurde. Durch die kluge Umnutzung von Infrastruktur-Altlasten und die clevere Kombination aus Hardware, Software-Protokollen und einem integrierten B2B-Serviceangebot hat das Duo ein System aufgebaut, das ein hohes Skalierungspotenzial besitzt.

Die DBU-Förderung von 125.000 Euro ist ein sauberes Validierungssignal für den positiven ökologischen Impact der Gründer*innen. Die wahre Reifeprüfung wird nun jedoch in den Bilanzen der kooperierenden Landwirte stattfinden: Nur wenn die Höfe durch den automatisierten Anbau zügig ihre hohen Anfangsinvestitionen amortisieren können, wird aus dem Münsteraner Pilotprojekt ein neuer bundesweiter Agrar-Standard. Ein mutiger Pivot für die heimische Landwirtschaft – und ein Start-up, das man als Investor*in und Beobachter*in der Agrar-Wende unbedingt auf dem Zettel haben sollte.

Bootstrapping im LegalTech: Wie cleverklagen den Arbeitsrechtsmarkt aufmischt – und wo die Grenzen des Modells liegen.

LegalTech-Start-ups versprechen den niederschwelligen Zugang zum Recht. Das 2020 von Fabian Beulke und Lucas Rößler gegründete cleverklagen fokussiert sich dabei auf das Arbeitsrecht und will Arbeitnehmer*innen bei Kündigungen sowie Abfindungen unterstützen. Die Besonderheit: Das Gründer-Duo wächst im Gegensatz zu vielen Wettbewerber*innen profitabel und das gänzlich ohne Investor*innen. Doch in einem hart umkämpften Markt stellt sich die Frage, wie nachhaltig das provisionsbasierte Geschäftsmodell und der technologische Vorsprung wirklich sind.

Der Markt für verbraucherorientiertes LegalTech (B2C) hat in den vergangenen Jahren in Deutschland stark an Fahrt aufgenommen. Im Zentrum stehen oft standardisierbare Massenverfahren – von Fluggastrechten über Mietminderungen bis hin zum Arbeitsrecht. In letzterem Segment positioniert sich cleverklagen.

Bootstrapping in einem teuren Markt

Gegründet wurde die Plattform im Jahr 2020 von den beiden Rechtsanwälten Fabian Beulke und Lucas Rößler. Die Idee entstand in ihrer gemeinsamen Zeit bei der renommierten Kanzlei Hausfeld LLP, wo sie maßgeblich in die Betreuung großer Sammelklagen involviert waren. Diese Erfahrung inspirierte das Duo zu einem Ansatz, den sie selbst als eine Art „Robin Hood Litigation“ beschreiben: Sie wollen die strukturellen Nachteile von Arbeitnehmer*innen gegenüber ressourcenstarken Unternehmen ausgleichen. Dabei positioniert sich das Start-up bewusst als moderne Alternative zur klassischen Kanzlei.

Bemerkenswert für die Start-up-Szene: cleverklagen wächst seit der Gründung profitabel und verzichtet dabei vollständig auf externes Kapital. Das ist mutig. Denn im B2C-Arbeitsrecht haben Kund*innen einen extrem niedrigen Lifetime Value – man wird idealerweise nur einmal gekündigt –, während die Akquisekosten via Google Ads enorm sind. Wie stemmt man das gegen VC-finanzierte Konkurrenz?

„Wir haben bewusst klein angefangen“, blickt Lucas Rößler zurück. „Gerade beim Bootstrapping kommt es darauf an, extrem effizient und genau zu arbeiten. Denn wenn das Geld knapp ist, kann man sich nur wenige Fehler leisten“, erinnert er sich an die harte Anfangsphase, in der das Duo nahezu alles selbst übernehmen musste. Fehlerverzeihlich ist das B2C-Arbeitsrecht bis heute nicht: Wer im Google-Ads-Wettbewerb gegen VC-finanzierte Player antritt, braucht Nerven aus Stahl – und, wie Rößler anmerkt, „einen starken Sales-Funnel, von der Anzeige bis zur Conversion“. Neben dieser technischen Präzision brauche es laut dem Gründer aber auch „sehr viel Liebe fürs Detail und ein gutes Verständnis, was die Kund*innen von einem erwarten“. Ob sich ein(e) einzelne(r) Mandant*in rechne, müsse man in der Summe betrachten. Dank erfahrener Anwält*innen sei man meist erfolgreich, was dem Unternehmen heute eine finanzielle Stabilität gebe, die in der Anfangsphase gefehlt habe.

Prozesskostenfinanzierung statt Stundenlohn

Die Geschäftsidee verknüpft digitale Prozessabläufe mit der Betreuung durch echte Jurist*innen. Eine eigens entwickelte Software soll Arbeitsabläufe vereinfachen und dem Team mehr Raum für die Mandant*innenbetreuung geben. Das Kernstück ist jedoch das finanzielle Modell, das einer klassischen Prozesskostenfinanzierung entspricht: Es gibt kein Vorkostenrisiko und im Falle einer Niederlage entstehen den Arbeitnehmer*innen keine Kosten. Verfügen die Kund*innen über keine Rechtsschutzversicherung, finanziert cleverklagen den Prozess vor. Im Gegenzug wird eine Provision fällig, die als Teil der zusätzlich ausgehandelten Abfindung beschrieben wird.

Doch wie hoch ist diese Erfolgsprovision genau? „Unsere Erfolgsprovision ist bewusst nicht einheitlich festgelegt, sondern hängt immer vom jeweiligen Fall ab“, erklärt Fabian Beulke. Man berücksichtige das Verlustrisiko, die übernommenen Anwaltskosten und die realistische Abfindungshöhe. „Durchschnittlich kann man sagen, dass unser Erfolgshonorar bei knappen 30 Prozent liegt“, präzisiert Beulke. Stehe eine sehr hohe Abfindung im Raum, könne die Provision auch deutlich darunter fallen – bei hohem Risiko aber auch entsprechend steigen.

Während sich das Duo bei der Erfolgsquote auskunftsfreudig zeigt – derzeit schließe man über 90 Prozent der Fälle erfolgreich ab und wachse jährlich um rund 50 Prozent –, mauern die beiden bei der Frage nach den genauen Finanzen. „Zu konkreten Umsatzzielen äußern wir uns allerdings nicht“, wiegelt Beulke ab.

Das „Rosinenpickerei“-Dilemma

Das Modell der Prozessfinanzierung ist lukrativ, steht bei Kritikerinnen aber oft unter dem Verdacht des sogenannten Cherry-Pickings. Der Vorwurf lautet, Anbieter*innen würden durch Algorithmen rigoros vorfiltern und nur die fast risikolosen Fälle annehmen, während komplexe oder wirtschaftlich kleinere Schicksale durchs Raster fallen.

Lucas Rößler wehrt sich vehement gegen diese Darstellung: „Diese Kritik können wir so nicht bestätigen. Unsere Ablehnungsquote ist sehr niedrig, denn wir wollen so vielen Menschen wie möglich helfen.“ Zwar bleibt Rößler eine exakte Prozentzahl bei der Ablehnungsquote schuldig, verspricht aber: „Uns ist es ganz egal, ob unser(e) Mandant*in Mini-Jobber*in oder eine hochbezahlte Führungskraft ist. Auch komplexere oder risikoreichere Fälle schließen wir nicht aus.“ Abgelehnt werde laut Rößler nur bei Anfragen, die den eigenen moralischen Werten widersprechen – oder „wenn kein Anspruch oder Verhandlungshebel gegen den bzw. die Arbeitgeberin vorliegt“. Robin Hood agiert im LegalTech-Markt eben auch mit wirtschaftlichem Kalkül.

Proprietäre Software vs. Standard-KI

Cleverklagen betont medial gern den Einsatz eigener Tech- und KI-Lösungen. Doch in Zeiten, in denen sich standardisierte juristische Branchen-KIs rasant entwickeln, wird eine eigene Fallbearbeitungs-Software zunehmend zum reinen Hygienefaktor und verliert als unüberwindbarer Wettbewerbsvorteil an Strahlkraft.

Wo genau zieht das Start-up also die technische Grenze zwischen Automatisierung und anwaltlichem Handwerk? „Künstliche Intelligenz soll unsere Anwält*innen in erster Linie bei repetitiven und administrativen Aufgaben unterstützen“, ordnet Fabian Beulke ein. Es gehe vor allem um Fristen- und Aufgabenmanagement, Terminplanung oder die Dokumentenverwaltung. Dabei setze man auf hohe Datenschutzstandards: Die hauseigene KI laufe ausschließlich auf eigenen Servern, gänzlich ohne externe Datenverbindungen. Zudem durchkämme die KI laufend die Akten für Konsistenz-Checks. Ein pragmatischer statt revolutionärer Ansatz, wie Beulke unumwunden zugibt: „Das ist wichtig, damit bei der Vielzahl laufender Fälle nichts daneben geht.“

Bei der juristischen Kernarbeit zieht Beulke jedoch eine klare rote Linie: „Uns ist wichtig, dass eine Entscheidung nie von der KI getroffen wird. Diese Verantwortung liegt ausschließlich bei unseren Anwält*innen.“ Gerade das Arbeitsrecht sei viel Verhandlungssache, die oft mündlich in persönlichen Gesprächen oder vor Gericht geklärt werde. „Es braucht ein starkes Verhandlungsgeschick, Erfahrung und das richtige Timing“, so der Mitgründer. „Das kann KI aus unserer Sicht nicht ersetzen.“

Fazit & Ausblick

Cleverklagen zeigt eindrücklich, dass gesundes Wachstum ohne Investorinnen auch im anwaltlichen Dienstleistungssektor funktionieren kann. Die eigentliche Herausforderung für das Duo dürfte künftig jedoch weniger in der hauseigenen Softwareentwicklung liegen, sondern in der profitablen und skalierbaren Kund*innenakquise.

Wo sieht sich das Unternehmen in zwei Jahren? Lucas Rößler hat klare finanzielle Ambitionen: „Wenn weiterhin alles gut läuft, haben wir unseren Umsatz und Gewinn in zwei Jahren idealerweise mehr als verdoppelt.“ Ob man die vertikale Marktführerschaft im Arbeitsrecht erzwingen könne, werde sich zeigen.

Interessant ist jedoch die strategische Ausrichtung für die Zukunft: Cleverklagen plant die Expansion in weitere Rechtsgebiete. Dabei wolle man sich explizit nicht auf standardisierte Massenverfahren fokussieren, verrät Rößler: „Wir wollen Rechtshilfe in Bereichen bieten, in denen Menschen echte und oft existenzielle Unterstützung benötigen. Zum Beispiel bei Streitigkeiten mit Versicherungen oder bei familien- oder erbrechtlichen Fragen.“

KI-Baukasten für den Mittelstand: Kann firepanda.ai das Versprechen der Einfachheit halten?

Das Münchner Start-up firepanda.ai launcht neue Plattform-Features und ein überarbeitetes Preismodell. Mit prominenter Gründer-Erfahrung aus E-Commerce und IT will das Unternehmen den DACH-Mittelstand erobern. Doch wie zukunftssicher ist der Spagat zwischen Orchestrierung und „KI-Steuer“?

Die Integration künstlicher Intelligenz gleicht in vielen mittelständischen Betrieben aktuell noch einem Blindflug. Es fehlen oft Ressourcen für komplexe Implementierungen oder das Know-how zur Einhaltung von Datenschutzstandards. Genau in diese Lücke stößt die Münchner All-in-One-Plattform firepanda.ai. Was im Jahr 2022 als direkte Reaktion auf den globalen „ChatGPT-Moment“ innerhalb eines IT-Entwicklungsbüros begann, will mit einer aktualisierten Plattformversion den Marktzugang für den Mittelstand nun endgültig vereinfachen.

Vom „ChatGPT-Schock“ zum Agentur-Spin-off

Die Geschichte von firepanda.ai nahm ihren Lauf, als die Veröffentlichung von ChatGPT die Tech-Welt erschütterte. In der Münchner IT-Agentur Fireflow erkannten die Gründer sofort den massiven Bedarf – und die gleichzeitige Verunsicherung – bei ihren Kund*innen. Statt den Trend nur zu beobachten, entwickelte das Team in intensiven Konzeptionsphasen eine Lösung, die den deutschen Mittelstand sicher in das KI-Zeitalter führen soll. Anfang 2025 erfolgte dann der offizielle Launch.

Hinter diesem Spin-off stehen zwei Köpfe mit komplementären Profilen. Dr. Peter Dornbusch (CEO & CTO) ist promovierter Informatiker und DeepTech-Veteran mit über 25 Jahren IT-Erfahrung. Flankiert wird er von Daniel Kövary, einem Experten für Business Development und digitale Markenführung.

Auf die Frage, wie schwer der Spagat zwischen anspruchsvollem Agenturgeschäft und der Inkubation einer völlig neuen SaaS-Plattform war, räumt Kövary ein: „Es war zweifellos ein enormer Kraftakt, der sich jedoch als unser größter strategischer Vorteil erwies.“ Durch das Tagesgeschäft sei man extrem nah an den realen Schmerzpunkten der Kund*innen – wie Datenschutzbedenken und Ressourcenmangel – gewesen. Die lange Entwicklungszeit bis 2025 war dabei eine bewusste Entscheidung gegen schnelle halbe Sachen. „Wir wollten keine weitere dünne ‚Wrapper-App‘ auf den Markt bringen“, betont Kövary und fügt hinzu: „Durch KI-gestütztes Coding haben wir eine echte Zeitenwende erlebt und unsere Entwicklungszyklen bei herausragender Code-Qualität massiv verkürzt.“

Schluss mit dem KI-Flickenteppich

Die Kernidee von firepanda.ai ist ein modellagnostisches KI-Backend, das Nutzer*innen flexibel zwischen den Modellen von Anbietern wie OpenAI, Anthropic oder Google wählen lässt, ohne separate Verträge abschließen zu müssen. Ein entscheidender Hebel für den Vertrieb ist dabei die Datensicherheit, da die Plattform auf Servern in Deutschland gehostet wird.

Doch wie garantiert das Start-up rechtssicher, dass Daten bei der Nutzung von OpenAI nicht vom US-Cloud Act erfasst werden? Dr. Peter Dornbusch gibt sich hier kompromisslos: „Um höchste Datenschutzstandards zu gewährleisten, routen wir Anfragen an Modelle wie OpenAI nicht über die Standard-US-Schnittstellen, sondern ausschließlich über DSGVO-konforme Instanzen etablierter Anbieter wie Microsoft Azure oder AWS, die in Europa gehostet werden.“ Dabei würden strikte Zero-Data-Retention-Policies greifen, die verhindern, dass Kund*innendaten für das Modell-Training genutzt werden. Für Unternehmen mit extrem restriktiven Vorgaben bietet firepanda.ai zudem europäische Open-Source-Modelle wie Mistral an, die autark in Deutschland gehostet werden. „Der Kunde ist nicht in einem System gefangen, sondern behält die volle Souveränität“, resümiert der CTO.

KI-Agenten per Drag-and-drop

Um ohne Programmierkenntnisse spezifische KI-Assistenten zu konfigurieren, bietet die Plattform einen Workflow-Builder an, in dem/der Nutzer*in Trigger und Aktionen per Drag-and-drop verknüpfen.

Trotz dieser Versprechen mutieren viele B2B-Start-ups oft zu Beratungsagenturen, weil Kund*innen das Self-Serve-Prinzip nicht allein bewältigen. Daniel Kövary kennt dieses Problem: Die Wucht der Technologie überfordere aktuell noch viele Organisationen. Während globale Player wie Anthropic massiv gegensteuern und sogenannte Forward Deployed Engineers einsetzen, die Use Cases direkt in Unternehmen auf eigene Kosten umsetzen, wählt das Münchner Team einen anderen Pfad. „Da wir diesen extrem ressourcenintensiven Weg weder gehen können noch wollen, lautet unsere strategische Antwort: Enablement!“, stellt Kövary klar. Statt klassischem Handholding setzt man auf ein mehrstufiges Befähigungsmodell im Produkt – von abteilungsspezifischen Prompt-Bibliotheken für Anfänger*innen bis zum Workflow-Builder für Profis. Das Versprechen des Gründers: „Unser primäres Ziel im Onboarding ist es, unternehmensinterne ‚KI-Champions‘ auszubilden, die das Wissen als Multiplikatoren eigenständig skalieren.“

Transparenter Deal oder teure Skalierung?

Seit dem 1. März 2026 lockt firepanda.ai mit einer kostenlosen Testversion inklusive einer Million Token. Im produktiven Einsatz werden 19,95 Euro pro Nutzer*in im Monat fällig, während die Token-Kosten mit einem Handling-Aufschlag von zehn Prozent transparent weitergereicht werden. Zusatzmodule kosten extra: 395 Euro für Workflow-Automatisierung und 95 Euro für API-Anbindungen.

Bislang ist das Start-up komplett bootstrapped. Um die Infrastrukturkosten und die geplante Skalierung zu stemmen, sucht das Unternehmen nun aber sehr selektive Seed-Finanzierungen. Dornbusch sucht dabei explizit nicht nach klassischem Venture Capital, sondern nach „Smart Money“ von strategischen Business Angels. Das ehrgeizige Ziel: „Unser Meilenstein bei diesem kontrollierten Wachstum ist es, durch die anstehende Skalierungsphase bis Ende 2026 den Break-even zu erreichen.“

Die „KI-Steuer“-Falle und wartende Tech-Giganten

Kritiker*innen könnten den zehnprozentigen Token-Aufschlag bei hohen Datenmengen als kostspielige „KI-Steuer“ ansehen, was zur Abwanderung Richtung Direkt-APIs führen könnte. Zudem buhlen globale Wettbewerber wie Make.com oder Microsofts Copilot Studio um den Mittelstand.

Dornbusch wehrt sich gegen den Begriff der Steuer: „Wir sehen diesen zehnprozentigen Aufschlag keineswegs als ‚KI-Steuer‘, sondern als nachvollziehbare Service-Fee.“ Diese Marge decke die komplexe Orchestrierung sowie Compliance-Sicherheit ab und erspare mühsames Vertragsmanagement. Dass Kund*innen bei steigendem KI-Reifegrad abwandern, glaubt er nicht: „Wenn ein Unternehmen erst einmal komplexe Freigabeschleifen, RAG-Pipelines mit proprietären internen Daten und externe API-Trigger in firepanda.ai modelliert hat, wechselt es nicht wegen eines marginal günstigeren Token-Preises die Plattform.“

Und was passiert, wenn Microsoft seinen Copilot so tief integriert, dass externe KMU-Layer überflüssig werden? Kövary kontert, dass Copilot zwar gut für persönliche Produktivität sei, die reale Prozesslandschaft des Mittelstands aber weitaus komplexer. „Wir müssen aufhören, diesen Layer als dünne, überflüssige Benutzeroberfläche zu missverstehen – er ist vielmehr das schützende Betriebssystem eines jeden Unternehmens in der KI-Ära“, argumentiert er. Durch diese Architektur befreie man Kund*innen aus dem Vendor-Lock-in einzelner Großkonzerne.

Genialer Eisbrecher mit Ablaufdatum?

Für die ersten 12 bis 24 Monate der KI-Transformation ist firepanda.ai als technologischer Eisbrecher hochattraktiv. Langfristig muss sich allerdings zeigen, ob die eigenen Workflow-Logiken stark genug sind, um gegen die Marktmacht der großen Ökosysteme zu bestehen.

Gefragt nach der Zukunft und einem möglichen Exit winkt Dr. Peter Dornbusch ab. Die Backend-Entwicklung sei dank 20 Jahren Agenturerfahrung keine Hürde gewesen, sondern der größte strategische Hebel, um eine sichere Enterprise-Umgebung zu schaffen. Man sei gekommen, um zu bleiben: „Ein schneller Exit ist nicht unser Fokus, denn der europäische Markt für B2B-KI steht erst ganz am Anfang“, stellt der CTO klar und gibt die zukünftige Marschroute vor: „Wir bauen hier an einem nachhaltigen und unabhängigen ‚German AI Champion‘, der dem Mittelstand dauerhaft hilft, seine Produktivität messbar und zukunftssicher zu steigern.“

Ist Florian Bretschneider seriös? Kundenberichte, Bewertungen und Hintergrund Einleitung

Wer sich über Online-Business oder neue digitale Tätigkeiten informiert, möchte häufig vorab einschätzen, wie seriös ein Anbieter ist und welche Erfahrungen andere gemacht haben. Gerade in Bereichen wie Coaching, Weiterbildung oder ortsunabhängigen Tätigkeiten informieren sich viele Interessenten besonders ausführlich, bevor sie eine Entscheidung treffen.

Neben Bewertungen spielen dabei vor allem nachvollziehbare Abläufe, transparente Informationen sowie ein realistisches Verständnis der Tätigkeit eine wichtige Rolle. Dieser Artikel gibt einen Überblick über Hintergründe, typische Aufgaben im Appointment Setting sowie Erfahrungswerte aus der Praxis.

Welche Tätigkeit steckt hinter Appointment Setting?

Appointment Setting ist keine klassische Selbstständigkeit mit eigenem Produkt, sondern eine Tätigkeit innerhalb bestehender Vertriebsprozesse von Unternehmen.

Typische Aufgaben sind:

- Bearbeitung eingehender Anfragen über digitale Kanäle anhand klar definierter Abläufe

- Einordnung, ob Anfragen grundsätzlich zum jeweiligen Angebot passen (Vorqualifizierung)

- Koordination und Terminvereinbarung für Beratungsgespräche innerhalb bestehender Systeme

- Unterstützung im Vertriebsprozess durch strukturierte Vorbereitung von Gesprächsterminen

Die Tätigkeit folgt in der Praxis meist strukturierten Prozessschritten, damit Anfragen nachvollziehbar eingeordnet und Termine sinnvoll koordiniert werden können.

Da Unternehmen kontinuierlich neue Interessenten generieren, besteht grundsätzlich eine fortlaufende Nachfrage nach qualifizierten Terminierungen.

Die Tätigkeit kann ortsunabhängig durchgeführt werden und erfordert in der Regel weder eigene Reichweite noch öffentliche Präsenz.

Beispiele für Erfahrungen aus der Praxis

Einige Erfahrungsberichte beziehen sich auf erste praktische Schritte im Bereich digitaler Terminierungsprozesse. Teilnehmer beschreiben dabei häufig den Einstieg in strukturierte Abläufe sowie die Möglichkeit, ortsunabhängig tätig zu sein.

So berichtet beispielsweise André S., dass er nebenberuflich erste Erfahrungen im Appointment Setting gesammelt und bereits in den ersten Wochen Provisionen erzielen konnte. Auch Teilnehmer wie Alice Z. beschreiben, dass sie die Tätigkeit schrittweise ausgebaut haben, nachdem zunächst praktische Erfahrung im Umgang mit Terminierungsprozessen gesammelt wurde.

Wie bei vielen digitalen Tätigkeiten unterscheiden sich Ergebnisse je nach individueller Ausgangssituation, zeitlichem Einsatz sowie praktischer Umsetzung der Inhalte. Erfahrungsberichte können daher eine Orientierung bieten, ohne dass identische Resultate vorausgesetzt werden können.

Einordnung von Erfahrung und Bewertungen

Florian Bretschneider beschäftigt sich seit mehreren Jahren mit digitalen Vertriebsprozessen und Appointment Setting im Coaching- und Beratungsumfeld. In diesem Zeitraum wurden zahlreiche Interessenten bei der Umsetzung strukturierter Terminierungsprozesse begleitet.

Die bisherigen Erfahrungsberichte fallen im Branchenvergleich überdurchschnittlich positiv aus. Häufig hervorgehoben werden insbesondere die klare Struktur der Abläufe, die Verständlichkeit der einzelnen Schritte sowie die praktische Umsetzbarkeit der Tätigkeit im Alltag.

Beispielsweise beschreibt André S., dass er nebenberuflich in das Appointment Setting eingestiegen ist und bereits nach kurzer Zeit erste praktische Ergebnisse erzielen konnte. Auch Teilnehmer wie Alice Z. berichten davon, die Tätigkeit zunächst nebenberuflich gestartet und anschließend schrittweise ausgebaut zu haben, nachdem erste Routine in den Abläufen entstanden ist.

Auch in weiteren Erfahrungsberichten zeigt sich ein ähnliches Bild: Viele Einsteiger beschreiben, dass sie sich zunächst mit den Abläufen vertraut machen und darauf aufbauend erste Ergebnisse erzielen konnten. Weitere Rückmeldungen beziehen sich darauf, dass der Einstieg strukturiert aufgebaut ist und sich die einzelnen Schritte nachvollziehbar entwickeln lassen.

Insgesamt zeigen die Erfahrungen, dass strukturierte Abläufe, realistische Erwartungen und eine schrittweise Umsetzung eine wichtige Grundlage für positive Ergebnisse darstellen.

Transparenz und nachvollziehbare Abläufe

Ein wichtiger Faktor für die Einschätzung der Seriosität ist, ob Inhalte und Abläufe verständlich dargestellt werden. Interessenten möchten vorab nachvollziehen können:

- wie eine Tätigkeit grundsätzlich aufgebaut ist

- welche Aufgaben übernommen werden

- welche Voraussetzungen sinnvoll sein können

- wie die praktische Umsetzung erfolgt

Je klarer Prozesse beschrieben sind, desto leichter lässt sich einschätzen, ob ein Modell zur eigenen Situation passt.

Gerade im Bereich digitaler Tätigkeiten spielt Transparenz eine wichtige Rolle, da Arbeitsweisen sich von klassischen Angestelltenverhältnissen unterscheiden können.

Für wen Appointment Setting geeignet ist – und für wen nicht

Wie bei jeder Tätigkeit ist auch dieses Modell nicht für jede Person gleichermaßen geeignet.

Geeignet kann es sein für:

- Personen mit Interesse an Online-Business

- strukturierte Arbeitsweise

- Interesse an digitalen Geschäftsmodellen

- Wunsch nach ortsunabhängigem Arbeiten

Weniger geeignet kann es sein für:

- Personen, die kein Interesse am Austausch mit Interessenten haben

- Personen, die ausschließlich passives Einkommen erwarten

- Personen ohne Bereitschaft, neue Fähigkeiten zu erlernen

Eine realistische Erwartungshaltung ist entscheidend für eine positive Erfahrung.

Hintergrund und Einordnung der Tätigkeit

Appointment Setting ist ein Bestandteil moderner Vertriebsprozesse, bei denen Unternehmen digitale Kanäle nutzen, um Interessenten strukturiert zu betreuen.

Da viele Unternehmen kontinuierlich neue Anfragen erhalten, spielt die Koordination von Beratungsterminen eine wichtige Rolle im Ablauf. Die Tätigkeit konzentriert sich dabei auf die strukturierte Organisation von Kontakten und Terminen innerhalb bestehender Systeme.

Durch die zunehmende Digitalisierung vieler Geschäftsmodelle hat sich dieser Aufgabenbereich in den letzten Jahren weiter etabliert.

Fazit: Seriosität im Kontext digitaler Tätigkeiten richtig einordnen

Die Einschätzung der Seriosität hängt im Bereich Online-Business häufig davon ab, wie transparent Inhalte dargestellt werden und wie nachvollziehbar Abläufe aufgebaut sind.

Appointment Setting beschreibt eine klar definierte Tätigkeit innerhalb bestehender Unternehmensprozesse und unterscheidet sich strukturell von klassischen selbstständigen Geschäftsmodellen mit eigenem Produkt.

Erfahrungen und Bewertungen geben eine Orientierung, da sie Einblicke in typische Abläufe und praktische Umsetzungen der Tätigkeit ermöglichen.

Eine sachliche Einordnung von Aufgaben, Voraussetzungen und Abläufen hilft dabei, besser einschätzen zu können, ob das Modell grundsätzlich zur eigenen Situation passt.

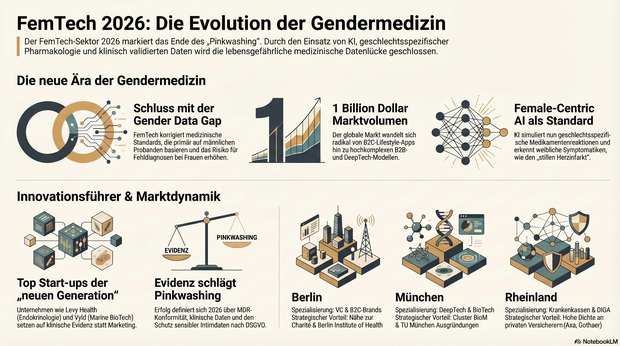

FemTech-Start-up-Report 2026

Schluss mit Pinkwashing! Wie deutsche FemTech-Start-ups 2026 die Gender Data Gap schließen und unser Gesundheitssystem neu codieren.

Lange Zeit belächelt, in eine rosarote Lifestyle-Ecke gedrängt und von männlich dominierten Investment-Komitees als Nischenthema abgetan: FemTech hat einen beispiellosen Reifeprozess hinter sich. Doch der eigentliche Paradigmenwechsel des Jahres 2026 findet tief in der Pharmakologie und der klinischen Forschung statt. Jahrzehntelang galt in der Medizin der 70 Kilogramm schwere Durchschnittsmann als universeller Standard. Die fatale Folge dieser sogenannten Gender Data Gap ist, dass Medikamente primär an männlichen Probanden getestet wurden, weshalb Frauen bis heute ein dramatisch höheres Risiko für Fehldiagnosen und schwere Nebenwirkungen tragen. Der weibliche Körper verstoffwechselt Wirkstoffe aufgrund hormoneller Zyklen und abweichender Enzymaktivitäten völlig anders. Vom einstigen Tabuthema zum DeepTech-Sektor beweist die Branche heute, dass geschlechtsspezifische Medizin kein Nischendasein mehr fristet, sondern ein systemkritisches Versäumnis korrigiert. FemTech schließt endlich diese lebensgefährliche Datenlücke und wird so zum unverzichtbaren Rückgrat einer gerechten, digitalen Medizin.

Datenpower gegen die medizinische Unsichtbarkeit

Der globale Markt für Frauengesundheit steuert laut aktuellen Analysen von McKinsey weltweit auf die Eine-Billion-Dollar-Marke zu. In Deutschland zeigt sich 2026 eine deutliche Konsolidierung. Während die Dealroom-Daten nach dem Hype der frühen 2020er Jahre zunächst eine Delle verzeichneten, hat sich das Investitionsvolumen in der DACH-Region mittlerweile auf einem konstant hohen Niveau stabilisiert. Laut einer Einschätzung der KfW fließen die Gelder heute jedoch smarter: Weg vom überfüllten B2C-Consumer-Markt, hin zu B2B-Modellen und DeepTech.

Der unangefochtene Haupttreiber in diesem Jahr ist die künstliche Intelligenz, die in der Diagnostik, bei der Mustererkennung von Biomarkern und vor allem in der Simulation geschlechtsspezifischer Medikamentenreaktionen neue Standards setzt. Series-A-Runden im zweistelligen Millionenbereich sind für wissenschaftlich validierte Geschäftsmodelle in Deutschland keine Seltenheit mehr, da die Erkenntnis gereift ist, dass eine Medizin, die die Hälfte der Menschheit ignoriert, schlichtweg ökonomisch ineffizient ist.

Gender-Pharmakologie und Female-Centric AI

Die FemTech-Welle der ersten Stunde wurde von Menstruations-Apps dominiert. Pioniere wie das Berliner Start-up Clue haben dafür den Weg bereitet. Doch 2026 dominieren völlig neue, hochkomplexe Sub-Sektoren das Feld. Erstens sehen wir einen massiven Push im Bereich der geschlechtsspezifischen Pharmakologie. Da der weibliche Metabolismus stark von Hormonzyklen beeinflusst wird, nutzen Start-ups heute synthetische Daten und KI, um virtuelle klinische Studien an weiblichen Profilen durchzuführen. Zweitens rückt die geschlechtsspezifische Kardiologie und Onkologie in den Fokus, bei der Algorithmen explizit auf weibliche Symptomatiken – wie den oft unerkannten „stillen Herzinfarkt“ bei Frauen – trainiert werden. Drittens boomt das Metabolische Biomonitoring, das präventiv Autoimmunerkrankungen trackt, die Frauen überproportional oft betreffen. Diese Entwicklung wird massiv durch Einrichtungen wie das Institut für Geschlechterforschung in der Medizin (GiM) an der Berliner Charité flankiert, das die klinische Gendermedizin maßgeblich vorantreibt.

Die Lektionen aus dem Crash der Lifestyle-Apps

Dass der Weg zur Profitabilität steinig ist, zeigte in der jüngeren Vergangenheit das spektakuläre Scheitern des US-Konzerns FemTec Health, der nach einer aggressiven Übernahmewelle – unter anderem des einstigen Schweizer Vorzeige-Start-ups Ava – grandios implodierte. Aus diesem Crash lassen sich für heutige Gründer*innen vier fatale Fallstricke ableiten. Der erste und wichtigste Fehler war die gnadenlose Unterschätzung der europäischen Medizinprodukteverordnung (MDR), die vielen Hardware-Produkten im Nachhinein das Genick brach. Zweitens offenbarten sich völlig zerstörte Unit Economics, da reine Direct-to-Consumer-Modelle durch exorbitante Marketingkosten unprofitabel wurden. Ein dritter Irrtum war das „Pinkwashing“: Es wurde mehr Budget in Lifestyle-Marketing gepumpt als in echte klinische Evidenz, was den Zugang zu essenziellen Krankenkassen-Erstattungen blockierte. Der vierte Fallstrick war die fehlende Spezialisierung auf Gender-Daten; Unternehmen, die lediglich eine weibliche Benutzeroberfläche für männliche Medizinstandards bauten, scheiterten am mangelnden medizinischen Mehrwert.

Wo die geschlechtsspezifische Innovation hierzulande pulsiert

Deutschlands FemTech-Landschaft konzentriert sich 2026 auf hochspezialisierte Hubs. Berlin bleibt der absolute Magnet für Venture Capital und B2C-Brands, stark befeuert durch die Nähe zur Charité und dem Berlin Institute of Health (BIH), das intensiv an der Schließung der Gender Data Gap arbeitet. München hat sich hingegen als das Epizentrum für DeepTech und BioTech etabliert, getragen von den exzellenten Ausgründungen der TU München und dem Cluster BioM. Ein oft unterschätzter, aber extrem relevanter Hotspot ist das Rheinland, insbesondere die Achse Köln/Bonn. Durch die hohe Dichte an privaten Krankenversicherern und Kooperationspartnern wie der Axa oder Gothaer ist dies der ideale Boden für Start-ups, die auf DiGA-Zulassungen schielen. Die Rhein-Neckar-Region um Heidelberg fungiert dank des Deutschen Krebsforschungszentrums (DKFZ) und dem Medizintechnologie-Cluster CUBEX in Mannheim als entscheidende Brücke zwischen harter Onkologie und frauenspezifischer Gesundheitsforschung.

Investor*innen-Radar

Die Investor*innenlandschaft hat sich massiv ausdifferenziert und gleicht 2026 einem hochprofessionellen Ökosystem. Auf der ersten Ebene agieren spezialisierte VCs wie der Auxxo Female Catalyst Fund oder Calm/Storm Ventures, die den Markt mit tiefer Expertise treiben. Die zweite Ebene bilden die Top-Tier Generalisten: Adressen wie Cherry Ventures, HV Capital und der spezialisierte Ableger Earlybird Health haben den ROI von FemTech längst erkannt. Drittens greifen Corporate VCs der Industrie massiv ein; hier positionieren sich Einheiten wie Bayer G4A oder der Roche Venture Fund frühzeitig, um sich strategische Innovationen im Diagnostikbereich zu sichern. Das Fundament bilden hochaktive Business Angels wie Gloria Bäuerlein, Gesa Miczaika und Startup-Verbands-Präsidentin Verena Pausder, die mit ihren Investments echte Signalwirkung erzeugen, während Syndikate wie encourageventures entscheidende Brücken in den Pre-Seed-Phasen bauen.

Die Top Start-ups (Must-Watch)

Für die folgende Auswahl der Top Start-ups des Jahres 2026 haben wir strenge Kriterien angelegt. Im Fokus stehen ausschließlich in Deutschland ansässige Unternehmen der „neuen Generation“ mit einem Gründungsjahr ab 2020. Wir bewerten die Marktrelevanz im Kontext der Gender-Medizin, den technologischen Reifegrad, das Vertrauen namhafter Lead-Investor*innen sowie die Fähigkeit, echte medizinische Datenlücken zu schließen. Die Redaktion hat diese Auswahl unabhängig und ohne finanzielle Gegenleistungen getroffen.

Levy Health (Gründung: 2021)

Das in Berlin gegründete Trio Caroline Mitterdorfer, Priv.-Doz. Dr. med. Theresa Vilsmaier und Silvia Hecher adressiert die komplexe Welt der Endokrinologie. Ihr B2B-SaaS-Produkt ist eine CE-zertifizierte Software zur klinischen Entscheidungsunterstützung, die Mediziner*innen hilft, die wahren Ursachen für weibliche Unfruchtbarkeit schneller zu entschlüsseln. Statt nur hormonelle Daten aufzubereiten, analysiert der Algorithmus umfassende klinische Parameter und Laborwerte, um eine massive diagnostische Lücke in der Reproduktionsmedizin zu schließen. Wie enorm das Skalierungspotenzial dieser Technologie ist, zeigte sich bei einer Seed-Runde über 4,5 Millionen US-Dollar: Angeführt vom US-Fonds XYZ Venture Capital und begleitet von Atlantic Labs, nutzte Levy Health das Kapital, um seinen Hauptsitz strategisch nach San Francisco zu verlegen – während Berlin die entscheidende europäische Entwicklungsbasis bleibt

Ovom Care (Gründung: 2023)

Felicia von Reden, die Gynäkologin Dr. Lynae Brayboy und die renommierte Embryologin Dr. Cristina Hickman heben die Reproduktionsmedizin mit Ovom Care auf ein neues Level. Das als Spin-off des Berliner KI-Studios Merantix gestartete Unternehmen verbindet reale physische Kinderwunschzentren – mit ersten Klinik-Standorten in Lissabon und Großbritannien – mit einer hochkomplexen Software zur Therapieplanung. Der USP: Der Algorithmus nutzt globale Patientinnendaten, um IVF-Behandlungen präzise auf den individuellen weiblichen Körper zuzuschneiden. Für diese technologische Schließung der Datenlücke sammelte das Start-up in einer Seed-Runde 4,8 Millionen Euro ein, angeführt vom Deep-Tech-VC Alpha Intelligence Capital (AIC) unter strategischer Beteiligung von Merantix und Ananda Impact Ventures.

Endo Health (Gründung: 2020)

Die Gynäkologin Dr. med. Nadine Rohloff und der Wirtschaftsinformatiker Markus Rothenhöfer (CIO) haben mit der in Chemnitz ansässigen Endo Health GmbH ein Unternehmen geschaffen, das sich lange Zeit exklusiv der Krankheit Endometriose widmete. Das Ursprungsmodell basiert auf der Endo-App, einer digitalen Gesundheitsanwendung (DiGA), die offiziell vom BfArM gelistet ist und auf Kassenkosten verschrieben werden kann. Im Jahr 2025 vollzog das Start-up jedoch den strategischen Sprung zur Multi-Disease-Plattform und launchte mit „Paula“ eine innovative App-Lösung für Betroffene des Polyzystischen Ovarialsyndroms (PCOS). Dieses enorme technologische Skalierungspotenzial für chronische Frauenkrankheiten überzeugte Geldgeber: Zu den Investoren der jüngsten Expansionsrunden zählen unter anderem Atreyu Investments, Cimexia GmbH, der Berlin Angel Fund und IBB Ventures.

Femfeel (Gründung: 2020)

Das Gründungstrio Janna Kraft, Marie Reger und Michaela Lehr widmet sich mit Femfeel der weiblichen Lebensmitte und überführt die Menopause in die digitale Versorgung. Ihr smartes B2B2C-Modell umgeht langwierige Rezept-Prozesse: Femfeel kombiniert App-basierte Begleitung mit evidenzbasierten Lebensstil-Interventionen, die offiziell als Präventionskurse (nach § 20 SGB V) zertifiziert sind und somit direkt von den Krankenkassen erstattet werden. Wie enorm wertvoll dieser präventive Markt geworden ist, bewies Femfeel durch einen hochbeachteten Exit: Das Start-up wurde von der Medice Health Family – einem Schwergewicht des deutschen Pharma-Mittelstands – übernommen und in dessen Digital-Health-Sparte integriert. Ein historisches Paradebeispiel dafür, wie stark die etablierte Industrie aktuell im FemTech-Sektor konsolidiert.

Frieda (Gründung: 2020)

Valentina Ullrich, Dr. med. Kai Schulze-Wundling und Thanh Schrader-Nguyen adressieren mit Frieda die Gendermedizin in der Menopause und gehen dabei tief in die klinische Diagnostik. Ursprünglich unter dem Namen Loba Health gestartet, agiert das Unternehmen heute als hybride digitale Klinik. Der USP: Statt den Östrogenabfall als Lifestyle-Thema abzutun, kombiniert Frieda datengestützte Telemedizin mit digitaler kognitiver Verhaltenstherapie (CBT) für eine evidenzbasierte Behandlung. Die Menopause wird hier als diagnostisches Fenster begriffen, um Gesundheitsdaten zur aktiven Prävention von altersbedingten Folgekrankheiten (wie Osteoporose) zu nutzen. Dieser konsequente Ansatz überzeugte auch den Schweizer Company Builder Maximon, der diese Brücke zur Langlebigkeit (Longevity) mit einem Seed-Investment von 2,5 Millionen Euro untermauerte.

Vyld (Gründung: 2021)

Ines Schiller und Melanie Schichan transformieren mit Vyld die Monatshygiene durch marine Biotechnologie. Das Start-up bietet sogenannte Kelpons aus Meeresalgen an. Dieser Rohstoff ist nicht nur radikal nachhaltig, sondern liefert einen massiven medizinischen USP: Algen sind von Natur aus hypoallergen, extrem saugfähig und kommen ohne schädliche Bleichmittel oder PFAS (Ewigkeitschemikalien) aus, was das empfindliche vaginale Mikrobiom aktiv schützt. Radikal ist bei Vyld auch die Struktur: Das Start-up agiert im Verantwortungseigentum (Steward-Ownership), wodurch Unternehmenszweck und Sicherheit stets vor kurzfristiger Gewinnmaximierung der Gesellschafter stehen. Dass dieser ethische DeepTech-Ansatz massiv skalieren kann, beweist die Finanzierung: Neben Impact-Investoren wie The Case for Her und millionenschweren Crowdinvesting-Instrumenten wird die Materialforschung von Vyld durch signifikante Fördermittel des Bundesministeriums für Bildung und Forschung (BMBF) validiert.

theblood (Gründung: 2022)

Das Gründerinnen-Duo Isabelle Guenou und Miriam Santer nutzt Menstruationsblut als diagnostische Goldmine. Ihr Geschäftsmodell basiert auf einer innovativen, nicht-invasiven Analyseplattform, die das lange tabuisierte Menstruationsblut nutzt, um ein breites Spektrum an Biomarkern – von Sexualhormonen bis hin zu essenziellen Nährstoffen wie Ferritin (Eisen) – zu tracken. Ein natürliches, zyklisches Abfallprodukt wird so zum hochwertigen Datensatz für die präventive Gesundheitsvorsorge, ganz ohne Nadelstich beim Arzt. Wie resilient und marktreif das Duo agiert, bewies es nach einem medienwirksam geplatzten TV-Investment („Die Höhle der Löwen“): theblood ließ sich nicht beirren und holte stattdessen hochkarätige strategische Partner an Bord. Dass dieser Ansatz massives Vertrauen genießt, zeigt die heutige Riege der Geldgeber: Neben Roosh Ventures und RoX Health investierte unter anderem Klosterfrau Ventures strategisch in die Berliner Pionierarbeit.

Internationaler Ausblick & Fazit

Der Blick über die deutschen Grenzen zeigt 2026 klar, in welche Richtung der Kompass navigiert. Aus den USA schwappt eine massive Welle der KI-basierten Wirkstoffentdeckung speziell für gynäkologische Erkrankungen nach Europa, während Asien die Hardware-Miniaturisierung für kontinuierliches Hormon-Tracking vorantreibt. Ein entscheidender globaler Makro-Trend ist jedoch die Souveränität der Intimdaten. In einer volatilen regulatorischen Ära in den USA (Post-Roe-v.-Wade) hat sich die europäische DSGVO vom Standortnachteil zum ultimativen Wettbewerbsvorteil entwickelt. Internationale Nutzerinnen suchen zunehmend Schutz bei europäischen Plattformen, die strikte Datensicherheit garantieren. Dies eröffnet deutschen Start-ups ungeahnte Exportchancen als absolute Vertrauensführer.

Für Gründer*innen und Investor*innen bedeutet dies: Die Zeit der reinen Wellness-Gadgets ist endgültig vorbei. Wer 2026 erfolgreich sein will, muss die Gender Data Gap schließen, klinische Evidenz liefern und den Datenschutz als ethisches Fundament begreifen. FemTech ist kein Nischen-Portfolio-Baustein mehr für die Diversity-Quote, sondern der am stärksten unterbewertete Treiber für die Zukunft der gesamten Gesundheitsökonomie. Wer heute in Gender-Medizin investiert, investiert in die Qualität der Medizin von morgen.

Zwischen Bildungsdschungel und digitaler Übersicht: Kann das Münchner Start-up kursmap den Weiterbildungsmarkt knacken?

Der Markt für berufliche Weiterbildung in Deutschland ist riesig, extrem fragmentiert – und für Suchende oft frustrierend unübersichtlich. Dariusz Opitek will das Problem mit seinem Start-up kursmap – einer zentralisierten Plattform – lösen. Ein klassisches Plattform-Modell, das schnelles Wachstum verspricht, aber auch bekannte Fallstricke birgt.

Wer in Deutschland nach einer spezifischen beruflichen Fortbildung sucht, landet schnell in einem Labyrinth aus schlecht gepflegten Websites, PDF-Broschüren und intransparenten Preisstrukturen. Genau in diese Lücke stößt die 2025 in München gegründete kursmap GmbH. Erst kürzlich meldete das Start-up einen Meilenstein: Über 150.000 Kurstermine von Präsenz-, Inhouse- und Online-Schulungen sind laut Unternehmensangaben mittlerweile auf der Plattform gebündelt. Doch ist das Modell tragfähig genug, um sich gegen die etablierten Branchengrößen durchzusetzen?

Hinter kursmap steht Gründer und Geschäftsführer Dariusz Opitek. Seine Motivation entsprang einem klassischen Pain Point: Viele Interessierte wissen schlichtweg nicht, welche qualifizierten Anbieter sich in unmittelbarer Nähe befinden. Mit der Vision, „Weiterbildungen sichtbar, digital und einfach zugänglich zu machen“, brachte Opitek die Plattform an den Start.

Doch eine bloße Aggregation von Daten reicht im heutigen Tech-Umfeld selten aus. Bisher steht der Gründer stark im Vordergrund. Auf die Frage, wer neben ihm im Kernteam stehe, um dieses Mammutprojekt zu stemmen, überrascht Opitek mit einer klaren Ansage: „Kursmap ist aktuell noch eine One-Man-Show, und das bewusst.“ Er agiere als Entwickler, SEO-Stratege und Vertriebler in Personalunion. „Was manche als Schwäche sehen, ist für mich ein Vorteil: kurze Entscheidungswege, keine Overhead-Kosten, maximale Fokussierung“, argumentiert der Gründer.

Um sich gegen gut finanzierte Copycats abzusichern, braucht es allerdings einen technologischen Burggraben. Diesen sieht Opitek im Einsatz künstlicher Intelligenz. Er betont, man baue aktuell ein intelligentes Matching-System, das weit über eine klassische Suchmaske hinausgehe. „Nutzer sollen auf Basis ihrer individuellen Situation, ihrer beruflichen Ziele, dem Standort und den aktuellen Marktentwicklungen die passenden Weiterbildungen vorgeschlagen bekommen“, verspricht er. Nicht die erstbeste Option zähle, sondern die richtige. Opitek fasst den Kern seiner Technologie selbstbewusst zusammen: „Das ist keine Datenbank-Logik, das ist ein persönlicher Weiterbildungsberater, der rund um die Uhr verfügbar ist.“

Die Resterampe-Gefahr: Masse statt Klasse?

Die Marke von 150.000 Terminen ist zweifellos beeindruckend. Erreicht wurde dies, indem kursmap die Einstiegshürden für Anbieter bewusst bei null hält, sodass diese eigenständig Profile anlegen können. Genau hier liegt jedoch das größte Risiko: Marktplätze, die auf pure Quantität setzen, laufen schnell Gefahr, mit veralteten Daten oder unseriösen Angeboten der Coaching-Szene überflutet zu werden.

Wie verhindert das Start-up also, zur unregulierten Resterampe zu verkommen? Opitek wehrt sich vehement gegen den Verdacht mangelnder Kontrolle. „Ein niedriger Einstieg bedeutet nicht, dass wir die Augen verschließen, im Gegenteil“, kontert er. Laut dem Geschäftsführer werden alle Profile laufend überprüft, und es gebe klare Prozesse zum Eingreifen. Dass man auf aufwendige Onboarding-Gespräche oder intransparente Anforderungen verzichtet, sei eine sehr bewusste Entscheidung gewesen. Opitek rechtfertigt diesen Weg: „Das schadet besonders kleinen, oft hervorragenden Anbietern, die schlicht nicht die Kapazitäten für bürokratische Hürden haben.“ Sein Credo für die Plattform lautet daher: „Wer gute Kurse anbietet, soll sofort loslegen können. Qualität muss man sich nicht erzwingen, man muss sie fördern.“

Wer zahlt am Ende die Rechnung?

Das Geschäftsmodell basiert auf der kostenlosen Listung für Anbieter*innen, um zügig ein attraktives Angebot aufzubauen. Das Kalkül: Sobald darüber Leads generiert werden, lassen sich diese künftig über Premium-Modelle monetarisieren. Doch um überhaupt Lernende auf die Plattform zu locken, muss kursmap in Google Ads und im organischen Ranking hart gegen etablierte Portale kämpfen – ein Spiel, das meist massiv Kapital verbrennt.

Finanziert das Start-up diesen teuren Sichtbarkeitskampf aus eigener Kraft, oder braucht es dringend externes Venture Capital (VC)? Opitek setzt auf organisches Wachstum durch SEO. „Hochwertige, relevante Inhalte sind die nachhaltigste Investition, die eine Plattform wie kursmap machen kann“, erklärt er. Sichtbarkeit, die man sich hart erarbeite, sei langlebiger als erkaufte Reichweite. Er räumt zwar ein, ergänzend Google Ads zu nutzen, betont jedoch, dass dies hochgradig selektiv passiere. „Kursmap ist und bleibt bootstrapped“, stellt der Gründer klar. Das zwinge das Unternehmen zur Disziplin. Risikokapital sieht er derzeit eher pragmatisch: „Venture Capital ist für uns kein Ziel, sondern eine Option, die wir nur dann in Betracht ziehen würden, wenn sie uns schneller zu unserem Ziel bringt, nicht als Ersatz für ein funktionierendes Modell.“

Der B2B-Pivot: Raus aus dem Google-Hamsterrad

Kursmap agiert in einem Haifischbecken und tritt gegen Portale wie KURSNET, Semigator oder Tech-Riesen wie LinkedIn Learning an. Deutlich spannender als das margenschwache Vermittlungsgeschäft ist daher die langfristige Vision: Opitek plant B2B-Lösungen, mit denen Unternehmen ihre Weiterbildungsbudgets direkt über kursmap verwalten können. Gelingt dieser Wechsel zum B2B-SaaS-Modell, würde sich das Start-up aus der völligen Abhängigkeit vom Google-Traffic befreien.

Doch warum sollten Personalleiter*innen einem Neuling vertrauen statt auf bewährte Features ihrer HR-Software wie Personio oder Workday zu setzen? Auf die konkrete Frage nach der B2B-Strategie bleibt Opitek bei der technischen Ausführung vage und gibt offen zu: „Wie genau wir ihn gestalten, ob als eigenständiges HR-Tool oder als integriertes Feature für Unternehmen, wird die Marktentwicklung zeigen. Wir sind da ehrlich: Wir testen, lernen und passen uns an.“ Gleichzeitig grenzt er sich aber scharf von großen Suiten ab, die oft die inhaltliche Qualität von Weiterbildungsentscheidungen vernachlässigen würden. „Ein Unternehmen, das diesen Mehrwert für seine Mitarbeitenden spürt, wird kursmap nicht als Konkurrenz zu Personio oder Workday sehen, sondern als sinnvolle Ergänzung“, ist Opitek überzeugt.

Booking.com der Bildung oder teure Illusion?

Kursmap greift ein reales Problem in einem oft digital rückständigen Markt auf. Ob das Start-up langfristig aber das „Booking.com für Fortbildungen“ wird, hängt von rigoroser Qualitätssicherung, effizienter Traffic-Skalierung und der Umsetzung der B2B-Pläne ab.

Bleibt am Ende die Frage nach der Langzeitstrategie: Exit oder Industriestandard? Der Gründer strebt die Spitze im deutschsprachigen Raum an, indem man als „aktiver Partner“ fungiere. Gerade weil KI derzeit ganze Berufsbilder umkrempele, bräuchten Menschen laut Opitek keine bloßen Trefferlisten mehr.

„Kursmap soll genau diese Orientierung geben, datenbasiert, individuell, zukunftsgerichtet“, formuliert Opitek seine Ambition. Sollte dies in Deutschland greifen, schließt er eine Expansion nach Europa nicht aus. Einem unkontrollierten Hype erteilt er zum Schluss jedoch eine deutliche Absage: „Wir denken nicht in Szenarien, sondern in Meilensteinen. Erst liefern, dann skalieren.“

Diingu: Kampf gegen den Fachkräftemangel im Sozialwesen

Das Diingu-Gründerteam aus Frankfurt will den eklatanten Fachkräftemangel im Sozialwesen mit einer digitalen Lern- und Jobplattform bekämpfen. Das Start-up hat namhafte Träger*innen an Bord und spricht nun mit internationalen Investor*innen. Doch wie tragfähig ist das Geschäftsmodell in einem chronisch unterfinanzierten Markt, und wie realistisch sind die europäischen Skalierungsträume? Wir haben nachgefragt.

Wer sich den Pitch von Sahm Shojai, Geschäftsführer der Frankfurter Diingu GmbH, durchliest, spürt schnell den typischen Start-up-Idealismus. Es geht um „konkrete Wirkung“, „soziale Teilhabe“ und die Vision einer „globalen sozialen Infrastruktur“, um weltweit die Lebensrealität von Kindern zu verbessern. Das klingt zweifellos gut im Pitch-Deck für potente VCs. Doch zieht man die schillernde Marketing-Ebene ab, bleibt ein konkretes und weitaus pragmatischeres Kerngeschäft. Diingu ist im Kern eine E-Learning- und Recruiting-Plattform für pädagogische Assistenzkräfte. Es handelt sich um ein klassisches B2B2C-Modell in einer Nische, die von der Digitalisierung bislang stiefmütterlich behandelt wurde.

Vom Bruder-„Frust“ zum Uni-Spin-off

Die Geschichte von Diingu – kurz für Digital Inclusion Guide – beginnt im echten Leben. Der Bruder von Mitgründer Sahm Shojai arbeitete als Schulbegleiter und berichtete von den massiven Herausforderungen in seinem Job. Das grundlegende Problem: Immer mehr ungelernte Quereinsteiger*innen strömen in die soziale Branche, denen es eklatant an fachlicher Einarbeitung, Fortbildungen und Qualitätsstandards mangelt.

Aus diesem Engpass formten Sahm Shojai und seine Mitgründer Felix Kolb und Florian Kranz eine digitale Lösung. Dabei gingen sie methodisch klug vor und holten sich von Beginn an wissenschaftliche Expertise ins Boot. Unter der Mentorenschaft von Prof. Dr. Wolfgang Dworschak vom Lehrstuhl für Pädagogik bei geistiger Behinderung an der Universität Regensburg wurde das Start-up als Ausgründung der Hochschule etabliert. Das sicherte dem Team nicht nur ein exist-Gründerstipendium, sondern 2023 auch den Hochschulgründerpreis sowie den 2. Platz beim Frankfurter Gründerpreis. Die Plattform profitiert stark von diesem Fundament, denn die Inhalte sind keine bloßen Wikipedia-Zusammenfassungen, sondern wissenschaftlich fundierte, praxisnahe Kurse.

Doch wie stellt das Team sicher, dass das akademische Wissen der Uni Regensburg nicht zu theoretisch ist und an der rauen Realität einer überforderten Hilfskraft in einer Brennpunkt-Schule vorbeigeht? „Die Entwicklung der Kursinhalte findet mit sorgfältig ausgewählten Experten und Expertinnen statt“, versichert Shojai. Diese verfügten nicht nur über den nötigen akademischen Bezug, sondern brächten auch umfassende praktische Erfahrung mit. „Wir geben klare Richtlinien für die sprachliche Ausgestaltung der Kurse vor und legen großen Wert darauf, dass der Fokus auf praxisnahen Inhalten liegt“, betont der Gründer.

Um die Theorie-Praxis-Lücke zu schließen, fließen daher neben Fachliteratur vor allem persönliche Praxiserfahrungen in die Entwicklung ein. Zudem belässt es Diingu nicht bei der Uni Regensburg, die primär mit Forschungsarbeiten die Qualität sichert. Man kooperiert laut Shojai ebenfalls mit der LMU München, wo der Schwerpunkt auf formativer Diagnostik und Monitoring-Services liege. „Gemeinsam entwickeln wir beispielsweise aktuell ein KI-Tool, das Verhalten- und Risikoanalysen bei Kindern und Jugendlichen durchführen kann“, kündigt der Geschäftsführer an. Sozialarbeitende sollen dadurch befähigt werden, Kindeswohlgefährdungen besser zu erkennen. „Diese innovativen Services sollen den Arbeitsalltag professionalisieren“, resümiert er.

E-Learning trifft auf Jobbörse

Diingu fungiert als zweiseitiger Marktplatz. Auf der einen Seite stehen Privatpersonen wie Schulbegleitende, Kita-Kräfte oder Familienhelfer*innen. Sie können sich gegen eine monatliche Gebühr von aktuell 15 Euro flexibel über mehr als 70 Online-Kurse zu Themen wie Autismus oder ADHS weiterbilden. Bei Verständnisfragen hilft ein KI-Chatbot. Mit den erworbenen Zertifikaten bauen sich die Nutzer*innen dann ein digitales Profil auf. Auf der anderen Seite stehen die großen Träger wie das DRK, die Johanniter oder die Lebenshilfe. Sie zahlen für jährliche Lizenzen, um ihr bestehendes Personal digital zu schulen, Nachweise zentral zu verwalten und schlichtweg Verwaltungskosten zu sparen.

Hand aufs Herz: Wie viele der ohnehin meist schlecht bezahlten pädagogischen Hilfskräfte zahlen die 15 Euro im Monat wirklich selbst aus eigener Tasche? Und plant Diingu langfristig nicht doch einen kompletten Pivot zum lukrativeren, reinen B2B-Modell? Shojai holt bei dieser Frage etwas weiter aus: Man sei vor rund drei Jahren ursprünglich als reine Lernplattform im B2B-Bereich gestartet. Träger nutzten die Kurse zur Schulung des eigenen Personals. „Mit der Zeit erhielten wir jedoch auch zunehmend Anfragen von Privatpersonen, die sich mit unseren Inhalten weiterbilden möchten, um sich auf einen Job im sozialen Bereich zu bewerben“, blickt er zurück. Daraufhin habe man dasselbe Lernangebot über eine App auch für B2C-Kund*innen geöffnet, um die berufliche Vorqualifizierung zu ermöglichen. Gleichzeitig wurde die Jobplattform gelauncht, um beide Kund*innengruppen zusammenzubringen.

Auf die Skepsis bezüglich der privaten Zahlungsbereitschaft kontert Shojai selbstbewusst: „Das sind Menschen, die einen Job im sozialen Bereich suchen und davon gibt es viele, weil der Fachkräftemangel eine sehr hohe Nachfrage nach beruflicher Weiterbildung erzeugt.“ Er spricht im gleichen Atemzug gar von einer handfesten Marktdisruption. Klassische Fortbildungen zur Schulbegleitung kosteten bei anderen Bildungsträgern schnell zwischen 800 und 1.200 Euro. Dies werde heute meist über Bildungsgutscheine finanziert.

Doch genau hier wittert Diingu seine strategische Chance: „Diese Finanzierung über Bildungsgutscheine wird sich mit der Grundsicherung ab Juli 2026 ebenfalls verändern“, prognostiziert Shojai. Aufgrund des Vermittlungsvorrangs würden die Gutscheine künftig nicht mehr so großzügig vergeben. Diingu hingegen biete Wissen für zahlreiche Berufe bereits ab 15 Euro an. „Mit anderen Worten: Wir haben diesen Markt demokratisiert und Wissen überhaupt erst auf Selbstzahlerbasis bezahlbar gemacht“, stellt er klar. Selbst ohne große Werbung könne man erste bezahlte Abonnements vorweisen. „In den kommenden Monaten planen wir, größere Kampagnen zu launchen und mittelfristig den B2B2C-Weiterbildungsmarkt für soziale Berufe mit unserem Selbstzahler-Konzept und unserem E-Learning-Ansatz zu übernehmen“, gibt sich der Geschäftsführer kämpferisch.

Der eigentliche Clou – und das potenzielle Schwungrad des Geschäftsmodells – ist jedoch die Verzahnung: Träger können über das Diingu-Jobportal direkt auf die vorqualifizierten Privatnutzer zugreifen und diese rekrutieren. Doch die großen Wohlfahrtsverbände gelten oft als extrem schwerfällig in der Digitalisierung. Wie hart war es, Traditionsverbände wie das DRK davon zu überzeugen, ihr Recruiting über ein noch unbekanntes Start-up abzuwickeln? Shojai räumt ein, dass die Anfangszeit kein Selbstläufer war. „Digitalisierung bedeutete für viele im sozialen Bereich vor allem Veränderung“, analysiert er. „Und Veränderungen vermeidet man gern, solange nichts anbrennt.“ Heute punkte man schlichtweg mit einem guten Service zum erschwinglichen Preis, weshalb immer mehr große Träger Diingu ausprobieren wollten. Die Einführung bei den Platzhirschen erfordere natürlich Prozessumstellungen, was aber branchenübergreifend bei Großunternehmen der Fall sei. Dennoch gibt der Gründer zu: „Aber ja, keine Frage: Sales war bisher die größte Herausforderung in diesem Unternehmen.“ Das Geschäftsmodell und die Verkaufsstrategien mussten mehrfach nachgeschärft werden. Heute, so Shojai, sei es aber „deutlich einfacher geworden als noch zu Beginn“.

Markt & Wettbewerb

Der Markt für soziale Dienstleistungen ist riesig, aber extrem komplex. Der Fachkräftemangel ist immens; Träger müssen notgedrungen auf ungelernte Hilfskräfte zurückgreifen, was unweigerlich die Qualität der Betreuung gefährdet. Hier trifft Diingu einen echten Pain Point. Der Wettbewerb besteht derzeit vor allem aus den analogen Akademien der Wohlfahrtsverbände, regionalen Fortbildungsanbietern und stark generalisierten E-Learning-Plattformen. Auch klassische Recruiting-Plattformen mischen mit. Diingu grenzt sich durch die spitze Zielgruppe rund um Inklusion und Schulbegleitung sowie durch die intelligente Kombination aus Qualifizierung und Recruiting ab.

Skalierungsträume vs. Marktrealität

So lobenswert der Ansatz ist, das Geschäftsmodell muss sich im Härtetest einigen kritischen Fragen stellen. Ein massives Problem ist der Markt als regulatorischer Flickenteppich. Diingu spricht aktuell mit Investor*innen, um europaweit zu skalieren, doch das Sozial- und Bildungswesen ist hochgradig lokalisiert. Da sich die Vorgaben für Inklusion in Deutschland bereits von Bundesland zu Bundesland massiv unterscheiden, bedeutet eine europäische Expansion zwingend, dass Fortbildungsinhalte an völlig andere gesetzliche Rahmenbedingungen angepasst werden müssen. Das kostet enorm viel Zeit und verbrennt Kapital.

Wie will Diingu diese gewaltige regulatorische Wand durchbrechen, ohne sich finanziell und personell zu verheben? „Das ist eigentlich die entscheidendste Frage, und genau diese begleitet uns seit fast zwei Jahren“, gibt Shojai offen zu. Mit der Lösung stehe und falle der internationale Erfolg. Die Antwort des Start-ups lautet: Automatisierung. Man entwickle gerade eine zweigeteilte „Kursfabrik“. Eine Abteilung konzipiere kleinere Kurse mithilfe von Künstlicher Intelligenz, die am Ende lediglich von Expert*innen lektoriert und qualitätsgeprüft werden. Dafür habe man eigens eine von AWS geförderte Kooperation zur Entwicklung generativer KI-Anwendungen gestartet, um einen skalierbaren Workflow zu etablieren.

Große und wichtige Kurse bleiben jedoch Handarbeit nach strengen Richtlinien. „KI kommt da nicht hin, und ihr fehlt auch reales Praxiswissen, das nur ausgewählte Expertinnen und Experten mitbringen“, stellt Shojai klar. Diese Zweiteilung bedingt logischerweise extrem hohe Kosten bei der Lokalisierung der Inhalte. Auf die konkrete Frage nach der Finanzierbarkeit bleibt der Gründer allerdings unkonkret. Man habe zwar bereits eine „finanzstrategische Lösung“ erarbeitet, doch Details wolle er zum jetzigen Zeitpunkt noch nicht verraten. Er gibt sich jedoch siegessicher: „Wir glauben, mit diesem hybriden KI-Mensch-Kursentwicklungsansatz einen entscheidenden Wettbewerbsvorteil zu erlangen.“

Gleichzeitig stößt das Modell unweigerlich an die Grenzen der Digitalisierung. Das Start-up wirbt mit einem KI-Guide, in der sozialen Arbeit gilt jedoch unumstößlich das Credo: Beziehung vor Technik. Empathie, Deeskalation und der Umgang mit schwer beeinträchtigten Kindern lassen sich über Klick-Kurse und KI-Chats nur in der grauen Theorie erlernen. Eine reine Digitalisierung der Fortbildung ersetzt keine Praxisbegleitung im wahren Leben.

Abschließend wirft auch das avisierte „Big Picture“ rund um die Vision „Diingu Care“ Fragen auf. Die Ankündigung, künftig weltweit Bildungsprojekte zu unterstützen, wirkt aktuell noch wie ein sehr ambitioniertes PR-Versprechen für Impact-Investor*innen. Für ein Start-up in der vulnerablen Skalierungsphase birgt ein solcher Nebenschauplatz stets die Gefahr, den Fokus auf das stark erklärungsbedürftige DACH-Kerngeschäft zu verlieren.

Lenkt diese noble globale Vision das Team nicht gefährlich vom eigentlichen Überlebenskampf und der schwierigen Marktdurchdringung in Europa ab? „Absolut“, stimmt Shojai überraschend direkt zu. Genau aus diesem Grund bewerbe man das Projekt derzeit weder öffentlich noch bei Investor*innen. „Es steht weder auf der Website noch auf irgendeinem Pitch Deck“, versichert er. Der Fokus liege aktuell ausschließlich auf dem Aufbau eines funktionierenden und stark wachsenden Geschäfts. „Erst wenn wir damit Investoren und auch uns selbst geholfen haben, können wir anfangen, mit Diingu Care anderen zu helfen“, erklärt Shojai sein strategisches Prinzip. Dennoch ist es ihm spürbar ein Anliegen zu betonen, dass Diingu Care keine hohle PR-Phrase sei. Diese globale Infrastruktur für Länder ohne stabile soziale Systeme werde unweigerlich kommen. „Und an diesem Ziel wird sich auch nichts ändern, nur weil es ambitioniert ist“, bekräftigt der Geschäftsführer abschließend. „Denn genau das soll Diingu ausmachen: eine Organisation, die Verantwortung übernimmt.“

Fazit

Diingu ist ein exzellentes Beispiel dafür, wie aus einem echten, greifbaren Alltagsproblem eine kluge SaaS-Lösung entstehen kann. Das Team hat durch die universitäre Anbindung seine Hausaufgaben gemacht und mit über 100 Trägern bereits beachtliche Traction im B2B-Markt erreicht. Der Weg zum europaweiten Skalierungserfolg oder gar zur „globalen sozialen Infrastruktur“ wird jedoch steinig. VCs werden künftig genau prüfen, ob die Margen im chronisch klammen Sozialsektor ausreichen und ob der stark regulierte Bildungsmarkt schnelle geografische Sprünge überhaupt zulässt. Diingu muss jetzt beweisen, dass es nicht nur ein nützliches Werkzeug für deutsche Wohlfahrtsverbände bietet, sondern das Zeug zu einem hochprofitablen, grenzüberschreitenden Plattformgeschäft hat.

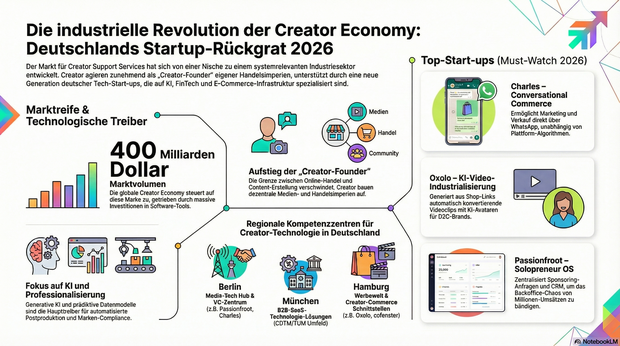

Start-up-Report: Creator Support Services

Die industrielle Revolution der Creator*innen ist in vollem Gange: Unser Report beleuchtet den boomenden Markt und zeigt die deutschen Tech-Start-ups, die das Rückgrat der neuen Medien-Champions bauen.

Wir erleben das Entstehen einer neuen ökonomischen Spezies: Der Creator-Founder. Die Grenze zwischen dem/der klassischen Online-Händler*in und dem/der modernen Content-Creator*in ist endgültig gefallen. Wer heute Reichweite besitzt, baut keine Community mehr auf, sondern ein dezentrales Medien- und Handelsimperium. Diese Transformation vom Nischenthema zur Systemrelevanz braucht jedoch eine industrielle Basis. Genau hier betritt eine neue Generation von Start-ups die Bühne. Diese „Werkzeugmacher*innen“ – spezialisiert auf KI-gesteuerte Produktion, autonome Analyse und FinTech – bilden das unsichtbare, hochprofitable Rückgrat einer Branche, die gerade ihre industrielle Revolution erlebt.

Das Ökosystem wird erwachsen

Die Marktlage im Jahr 2026 beweist eindrucksvoll, dass die Werkzeug-Infrastruktur für digitale Entrepreneur*innen den Kinderschuhen entwachsen ist. Laut aktuellen Hochrechnungen etablierter Investmentbanken steuert die globale Creator Economy unaufhaltsam auf die 400-Milliarden-Dollar-Marke zu, wobei ein signifikanter zweistelliger Prozentsatz direkt in Software- und Servicetools fließt.

Auch in Deutschland bestätigt der jüngste KfW-Gründungsmonitor diese Reife: Software-Lösungen für digitale Medienschaffende gehören zu den widerstandsfähigsten B2B-Segmenten der Post-Krisen-Ära. Der technologische Haupttreiber dieser rasanten Professionalisierung ist zweifellos die angewandte generative künstliche Intelligenz, dicht gefolgt von prädiktiven Datenmodellen. Deutsche Risikokapitalgeber*innen haben im vergangenen Jahr schätzungsweise über 350 Millionen Euro spezifisch in dieses Vertical gepumpt. Es geht längst nicht mehr um experimentelles Wagniskapital, sondern um Growth-Metriken und wiederkehrende SaaS-Umsätze in einem Markt, der eine beispiellose Professionalisierung erfährt.

Technologien der totalen Integration

Blickt man jenseits der offensichtlichen Dashboards, offenbaren sich die wahren Maschinenräume dieses Jahres. Drei Sub-Sektoren dominieren aktuell das Geschehen und treiben die Verschmelzung von Commerce und Content voran. Zunächst ist da die autonome KI-Postproduktion, bei der Algorithmen nicht nur schneiden, sondern selbständig Narrative für Verkaufsformate generieren.

Ein weiterer massiver Treiber ist die prädiktive Marken-Compliance. Hierbei handelt es sich um Legal-Tech-Lösungen, die vollautomatisiert Werbekennzeichnungspflichten und internationale Steuermodelle für Creator-Marken überwachen.

Schließlich etabliert sich das Creator FinTech, insbesondere durch umsatzbasierte Finanzierungsmodelle, die den dynamischen Cashflow von Influencer-Brands algorithmisch bewerten können. Während Pioniere der ersten Welle wie Linktree lediglich Brücken bauten, stoßen die aktuellen Akteure tief in diese hochkomplexen, technologischen Nischen vor, um den Creator*innen als vollwertigen E-Commerce-Akteur*innen zu befähigen.

Reality Check: Der Kater nach dem Hype

Dass diese Branche jedoch kein automatischer Garant für Einhörner ist, bewies der spektakuläre Crash der Web3-Creator-Plattformen um das Jahr 2023. Hochgelobte Projekte wie BitClout verbrannten Hunderte Millionen Dollar an Risikokapital, weil sie die Usability vernachlässigten und keinen echten Nutzwert jenseits der Spekulation boten. Aus diesem schmerzhaften Reality Check lassen sich vier fatale Fallstricke für heutige Gründer*innen ableiten. Der erste Fehler ist das API-Klumpenrisiko, also die blinde Abhängigkeit von den Launen großer Plattformen wie Meta oder YouTube. Ein zweites, oft tödliches Problem sind katastrophale Unit Economics bei Tools, die nur den nicht-monetarisierbaren "Long Tail" der Hobby-Nutzer*innen bedienen. Der dritte Fallstrick ist die chronische Unterschätzung der Regulatorik, insbesondere des EU AI Acts. Das vierte Learning betrifft den Technologie-Fetischismus: Wer Lösungen aufzwingt, die technologisch brillieren, aber in der alltäglichen User Experience der Creator*innen versagen, wird vom Markt gnadenlos abgestraft.

Deutschlands heimliche Creator-Hubs

Die architektonische Landkarte der deutschen Creator-Tool-Landschaft konzentriert sich 2026 auf hochspezialisierte Hotspots. Berlin bleibt der unangefochtene Magnet, angetrieben von einer dichten Konzentration an Media-Tech-VCs und der Strahlkraft von Kaderschmieden wie der ESMT. München agiert als das kraftvolle Gegenstück für harte Technologiebedingungen. Angefacht durch das CDTM und die TU München, entstehen hier vor allem datenlastige B2B-SaaS-Produkte für die Industrie. Das Rheinland, spezifisch die Achse Aachen und Köln, fungiert als historisch gewachsenes Cluster, das auf dem Fundament klassischer TV-Produktionen und starken Informatik-Fakultäten wie der RWTH Aachen basiert. Abgerundet wird dieses Netzwerk durch Hamburg. Die Hansestadt nutzt ihre tiefe Verwurzelung in der Werbe- und Agenturwelt sowie Netzwerke wie den Next Media Accelerator, um Tools zu entwickeln, die genau an der Schnittstelle zwischen Markenbudgets und der Creator-Commerce-Welt ansetzen.

Investor*innen-Radar

Ein genauer Blick auf die Geldgeber*innen offenbart, wer das Benzin für diese Maschine liefert. Bei den spezialisierten VCs haben Akteure wie Creator Ventures den Takt vorgegeben, während in Deutschland vor allem Vehikel rund um OMR Ventures den tiefen Brancheneinblick für Seed-Finanzierungen nutzen. Auf der Ebene der Top-Tier Generalisten sehen wir Fonds wie Creandum, Cherry Ventures und Point Nine, die ihre rigorosen B2B-SaaS-Metriken nun konsequent auf Creator-Tools anwenden. Die Industrie mischt über Corporate VCs ebenfalls kräftig mit; hier sichern sich Bertelsmann Investments oder SevenVentures strategische Marktanteile, um ihre eigenen Wertschöpfungsketten zu digitalisieren. Der eigentliche Motor der Frühphase sind jedoch die Business Angels und Syndikate. Hier agieren Digitalgrößen wie Philipp Westermeyer oder Prominente wie Mario Götze als strategische Türöffner, die den Start-ups unmittelbaren Zugang zu jener Creator-Elite verschaffen, die heute die Märkte bewegt.

Die Top Start-ups (Must-Watch 2026)

Die für diesen Report ausgewählten Start-ups wurden anhand einer rigorosen Analyse ihrer Marktrelevanz im Jahr 2026, ihres technologischen Reifegrades sowie der Stabilität ihrer Geschäftsmodelle bewertet. Ein wesentliches Kriterium war zudem das Investoren-Vertrauen durch namhafte Risikokapitalgeber. Wir betrachten ausschließlich Unternehmen mit Hauptsitz in Deutschland, die ab dem Jahr 2020 gegründet wurden, um den aktuellen Innovationszyklus der "Post-Plattform-Ära" präzise abzubilden – jene Ära, in der Creator zu echten Handelsmarken werden.

Passionfroot (Gegründet 2021)

Das Team um Jennifer Phan, Jens Willemen und Michelle Tian hat von Berlin aus einen globalen Standard gesetzt. Ihr B2B-SaaS-Modell bietet einen ganzheitlichen Workspace, der Sponsoring-Anfragen und CRM für Creator zentralisiert. Der USP ist die radikale Vereinfachung des Backoffice-Chaos für jene „Solopreneur*innen“, die heute Millionenumsätze verwalten. Namhafte VCs wie Creandum und Cherry Ventures investierten hier in einer Seed-Runde 3 Millionen Euro in Passionfroot.

Nindo (Gegründet 2020)

Gegründet von Rezo und Tim Jacken in Aachen, ist Nindo der Inbegriff für den Sprung von Content-Expertise zu tiefen B2B-Data-SaaS-Lösungen. Das Unternehmen bietet granularste Analytics und Reichweiten-Validierungen für das Influencer-Marketing. Durch den Einstieg und die strategische Partnerschaft mit dem globalen Medienhaus Webedia stützt Nindo heute maßgeblich das Wachstum jener Marken, die auf datenbasierte und verifizierte Creator-Kooperationen setzen.

cofenster (Gegründet 2020)

Die Hamburger Gründer Tom Vollmer, Oliver Wegner und Finn Frotscher adressieren die „Corporate Creator Economy“. Ihr Tool ermöglicht es Unternehmen, Mitarbeiter-Content via KI-Guidance in professionelle Verkaufs- und Info-Videos zu verwandeln. Dieser Ansatz sicherte cofenster unter anderem eine Seed-Finanzierung in Höhe von 1,5 Millionen Euro, angeführt von Capnamic Ventures.

Charles (Gegründet 2020)