Aktuelle Events

Die 5 größten No-Gos bei Landingpages

Landingpages sind wohl unbestritten eines der mächtigsten Instrumente, um Besuchende online von sich zu überzeugen und zu Leads oder gar Kund*innen zu konvertieren. Gleichzeitig gilt: Noch immer werden die immer gleichen Fehler gemacht. Die häufigsten unter ihnen können dabei in einer All-Time-List zusammengefasst werden. Wer die folgenden fünf Fehler vermeidet, hat bereits eine bessere Landingpage.

Landingpage, da war doch was? Das sind diese Must-haves. Wer was auf seinen Webauftritt hält, hat eine tolle Landingpage. Das Ziel dahinter ist eindeutig: Leads gewinnen, E-Mail-Adressen sammeln, Verkäufe generieren. Auch aus Sicht der Consumer respektive der User*innen gilt: Eine Landingpage ist wichtig. Ist sie unbrauchbar, stehen die Chancen sehr hoch, dass die Visits bei Null bleiben – von den Verläufen nicht zu sprechen. Dabei gibt es fünf typische Fehler, die eine Landingpage schlecht machen. Umgekehrt formuliert: Wer folgende fünf Klassiker vermeidet, hat eine bessere Landingpage.

Landingpage No-Go 1: Kein Vertrauen

Das wohl wichtigste Element einer Landingpage ist, dass sie sofort Vertrauen aufbaut. Sofort heißt sofort. Zur Erinnerung: Eine Website hat weniger als drei Sekunden Zeit, um Besuchende davon zu überzeugen, länger zu verweilen. Wer performt, macht User neugierig. Jenes Vertrauen kann aktiv erzeugt werden. Kundenlogos, Zertifikate, Reviews, Zahlen, Daten und Fakten oder Partner. Das sind nur ein paar der Möglichkeiten, um auf eigene Stärken aufmerksam zu machen. Zu Bescheidenheit ist dabei nicht geraten: Referenzen auf irgendeiner Unterseite zu verstecken, verfehlt den Effekt. Denn: Bis dahin kommen respektive lesen die Besuchenden wie gesagt gar nicht erst. Die Devise lautet daher tue Gutes und sprich darüber – sofort!

Landingpage No-Go 2: Kein Mehrwert

Nicht bescheiden zu sein, heißt jedoch auf gar keinen Fall, sich selbst voll in den Mittelpunkt zu stellen und nur über eigene Kompetenzen zu sprechen. Der Unterschied ist einfach: Es ist glaubhaft, wenn andere über die eigenen guten Taten sprechen. Wer selbst darüber spricht, lobt sich selbst – und das führt auch online zu dem begleitenden Geruch. Landingpages funktionieren daher besser, wenn sie den Usern einen Mehrwert liefern. Anstelle also über sich selbst zu philosophieren, ist es zielführender ein paar Tipps und Beispiele zu nennen. Das macht nicht arbeitslos, sondern transparent.

Landingpage No-Go 3: Kein Fokus

Es ist wie in der Schule: Wer sich ablenken lässt, verpasst wichtige Infos. Ergo: Setzens, sechs. Auch Besuchende einer Landingpage können von zu viel Bohei abgelenkt werden. Klar, was funkelt und glitzert, das erzeugt Aufmerksamkeit. Gemeint ist also nicht, dass eine langweilige Landingpage besser performt. Gemeint sind alle anklickbaren Optionen, die von der mühsam platzierten Kernbotschaft ablenken. Das Menü? Ausblenden! Links die wegführen? Entfernen! Gute Landingpages haben einen Fokus.

Landingpage No-Go 4: Kein CTA

Sind Referenzen positioniert, ist der Mehrwert geliefert und ist der Fokus eindeutig, folgt die klare Handlungsaufforderung – der berühmte Call-to-Action. Fehlt jedoch dieser CTA, war die Mühe bis hier her vergebens. Aber bitte: Keine langweiligen Einladungen. Niemand möchte jetzt Kontakt aufnehmen oder hier klicken, um was auch immer zu finden. Ist der CTA ein lustloser Button, dann erzeugt er ebenso wenig Lust zu drücken. Ist der CTA dagegen klar formuliert, erfüllt er gar die Sehnsucht der User, dann wird er auch angeklickt. In diesem Sinne: „Gib mir mehr Tipps“.

Landingpage No-Go 5: Kein Verständnis

Zu guter Letzt darf das Verständnis nicht fehlen. Nicht verstanden? Ganz einfach: Wer Modewörter nutzt, nur um fancy und cool zu sein – beziehungsweise fancy und cool zu wirken – wird enttarnt und verliert. Fachwörter sind in Ordnung, solange die Zielgruppe diese tatsächlich nutzt. Dann ist es sogar klasse, in der Sprache der User zu kommunizieren. Fachwörter sollten jedoch nicht den Zweck erfüllen, Eindruck zu schinden. Besser ist eine klare, einfache und gerne emotionale Sprache.

Fazit

Landingpages müssen knallen, damit sie verkaufen. Wer die fünf häufigsten Fehler vermeidet, hat dann schon deutlich bessere Karten. Anders ausgedrückt: Vertrauen schaffen, Mehrwert erzeugen, Fokus bilden, CTA reizvoll formulieren und verständlich sein.

Der Autor Kristijan Jurcic ist Webdesigner und Gründer von Krisnetics

Diese Artikel könnten Sie auch interessieren:

„Wir scheitern nicht an der Technologie, sondern an der Kommerzialisierung“

Warum wandern Europas DeepTech-Gründer*innen ab? Wie viel Schuld trägt das europäische Ökosystem daran – und wie viel die Gründer*innen selbst? Im Interview: Dr. Martin Schilling, Ex-N26-COO und CEO von Deep Tech Momentum, über fehlendes Risikokapital, mangelnde Traktion und den schweren Weg zur Skalierung.

Deutschland und Europa sind starke Quellen für DeepTech-Innovationen – aus Universitäten, Forschungseinrichtungen, Patenten und technischer Domänenexpertise. Dass wir hier in der Spitzenliga spielen, belegen Studien wie das European Innovation Scoreboard, des Europäischen Patentamts und der Max-Planck-Gesellschaft regelmäßig. Dennoch stehen wir vor einem massiven Problem: Es mangelt nicht an Innovationen selbst, sondern an ihrer Kommerzialisierung. Im Vergleich zu den USA, wo Investor*innen häufig früher und mit höherer Risikobereitschaft auf große technologische Wetten setzen, finden europäische Start-ups zu spät Kund*innen, Traktion und risikofreudiges Kapital. Weil Kommerzialisierung, Industrialisierung und Wachstum hierzulande oft langsamer verlaufen, entsteht für viele Gründer*innen ein struktureller Druck, Kapital und Skalierung in den USA zu suchen.

Einer, der diese Lücke an der Schnittstelle von Gründer*innen, Kapital und Unternehmenskunden aus erster Hand beobachtet, ist Dr. Martin Schilling. Der ehemalige COO von N26 und Managing Director von Techstars Berlin ist heute Co-Founder und CEO von Deep Tech Momentum (DTM). DTM ist Europas führende Plattform für DeepTech und AI Innovation, findet vom 20. bis 21. Mai 2026 in Berlin statt und bringt Unternehmen als potenzielle Kund*innen, DeepTech-Start-ups als Anbieter*innen und Investor*innen aktiv zusammen.

Wir wollten von Martin Schilling erfahren: Wie viel Schuld trägt das europäische Ökosystem an der geschilderten Misere – und wie viel die Gründer*innen selbst?

StartingUp: Martin, du stellst die These auf, es mangele in Europa nicht an DeepTech-Innovationen, sondern an der Kommerzialisierung. Machen wir es uns damit nicht zu einfach? Müssten wir nicht ehrlicherweise auch über die katastrophal langsamen IP-Transfer-Prozesse an deutschen Universitäten, überregulierte Märkte und den Fachkräftemangel sprechen, die Start-ups schon abwürgen, bevor sie überhaupt etwas kommerzialisieren können?

Martin Schilling: Ich glaube, wir dürfen uns hier nichts vormachen. Natürlich haben wir in Europa strukturelle Probleme wie langsame IP-Transfer-Prozesse, fragmentierte Märkte, Regulierung, Fachkräftemangel. Das alles ist real und bremst viele Entwicklungen aus. Aber diese Faktoren erklären nicht vollständig, warum wir trotz exzellenter Forschung so selten globale Kategorie-Gewinner hervorbringen.

Der entscheidende Punkt ist aus meiner Sicht ein anderer: In Europa denken wir Technologie oft zu lange aus der Perspektive der Forschung und zu spät aus der Perspektive des Marktes. In den USA wird viel früher gefragt: Wer zahlt dafür? Wie schnell kommen wir in echte Deployment-Szenarien? In Europa fragen wir zu lange, ob die Technologie perfekt ist. Das führt dazu, dass viele DeepTech-Start-ups zu spät mit echten Kunden interagieren, zu spät lernen und zu spät Traktion aufbauen. Die strukturellen Themen sind ein Teil des Problems. Aber die Art, wie wir Unternehmen bauen und die fehlende frühe Kommerzialisierungslogik sind aus meiner Sicht größere Hebel.

StartingUp: Du hast als COO bei N26 massives Wachstum miterlebt – ein B2C-FinTech mit einer App. DeepTech bedeutet aber oft jahrelange Forschung, Hardware-Entwicklung, Patente und B2B-Sales-Zyklen, die ewig dauern. Wie viel B2C-Wachstums-Mindset lässt sich überhaupt auf hochkomplexe DeepTech-Unternehmen übertragen, ohne an der Realität zu scheitern?

Martin Schilling: Man kann DeepTech nicht wie ein B2C-FinTech skalieren. Das wäre naiv. Die Zyklen sind länger, die Kapitalintensität höher, und die technische Unsicherheit ist real. Aber das heißt nicht, dass man auf ein Wachstums-Mindset verzichten kann. Was übertragbar ist, sind nicht die Taktiken, sondern die Prinzipien: Geschwindigkeit im Lernen, radikale Kundenorientierung und der Anspruch, früh zu skalieren und nicht erst, wenn alles perfekt ist.

Was ich oft sehe ist, dass DeepTech-Teams jahrelang die Technologie optimieren, bevor sie ernsthaft in den Markt gehen. In dieser Zeit verlieren sie wertvolle Iterationen. Die besten Teams denken von Anfang an in Dual Tracks: Technologie entwickeln und parallel kommerzielle Hypothesen testen. Das bedeutet nicht, dass man Hardware-Zyklen beschleunigen kann. Aber man kann sehr wohl beschleunigen, wie schnell man versteht, wo echter Bedarf ist und wie Zahlungsbereitschaft entsteht.

StartingUp: Ein ständiger Kritikpunkt ist, dass der Zugang zu mutigem Kapital in Europa langsamer funktioniert als in den USA. Aber VCs sind keine Wohlfahrtsverbände, sie rechnen Risiko und Rendite durch. Müssen wir nicht vielleicht zugeben, dass viele europäische DeepTech-Cases geschäftlich einfach nicht attraktiv oder zu schlecht gepitcht sind, um ein amerikanisches Risikoprofil anzuziehen?

Martin Schilling: Es ist zu einfach, alles auf fehlendes Kapital zu schieben. Ja, die USA haben mehr Kapital und mehr Risikoappetit. Aber Kapital folgt am Ende immer überzeugenden Geschichten und vor allem überzeugender Traktion. Was ich in Europa oft sehe: Technologisch brillante Teams, aber schwache Positionierung, unklare Go-to-Market-Strategien und zu wenig Fokus auf kommerzielle Meilensteine. Viele Pitches sind technisch beeindruckend, aber beantworten nicht die entscheidende Frage, warum aus etwas ein erfolgreiches Geschäftsmodell wird. Das heißt nicht, dass es kein strukturelles Kapitalproblem gibt. Das gibt es. Aber wir müssen genauso ehrlich sagen: Ein Teil des Problems liegt in der Art, wie wir DeepTech-Unternehmen bauen und erzählen.

StartingUp: Du beobachtest somit, dass deutsche Start-ups oft nicht an der Technologie, sondern an Marktanbindung und Traktion scheitern. Wenn die Technologie exzellent ist, scheitert es dann am Menschlichen? Wie oft erlebst du, dass brillante Forschende aus Eitelkeit nicht loslassen können und sich weigern, den CEO-Posten an erfahrene Business- und Sales-Profis abzugeben?

Martin Schilling: Das Thema gibt es, aber ich würde es differenzierter sehen. DeepTech entsteht oft aus wissenschaftlicher Exzellenz. Und diese Gründer*innen bringen etwas extrem Wertvolles mit: tiefes Verständnis, langfristiges Denken und eine hohe technische Vision. Die Herausforderung entsteht, wenn diese Stärken nicht durch kommerzielle Kompetenz ergänzt werden. Ich erlebe weniger ein klassisches „Ego-Problem“, sondern eher ein Rollenproblem, denn viele Gründer*innen haben nie gelernt, was es bedeutet, ein Unternehmen zu skalieren. Das gilt insbesondere im B2B-Kontext. Die besten Teams lösen das sehr pragmatisch. Sie bauen früh komplementäre Führungsteams mit starkem Sales-, Operations- und Marktverständnis auf. Ob das dann ein externer CEO ist oder nicht, ist zweitrangig. Entscheidend ist, dass die Organisation die Fähigkeiten hat, nicht nur Technologie zu entwickeln, sondern sie auch zu verkaufen.

StartingUp: Um Start-ups, Corporates und Investor*innen zusammenzubringen, veranstaltest du im Mai das Event Deep Tech Momentum in Berlin. Aber ganz ehrlich: Es gibt in Europa und Deutschland bereits hunderte Start-up-Konferenzen, Summits und Matchmaking-Events. Warum sollte ausgerechnet ein weiterer Marktplatz das tiefgreifende strukturelle Problem lösen, dass die deutsche Industrie oft schlichtweg zu risikoavers ist, um bei jungen Start-ups einzukaufen?

Martin Schilling: Ich stimme dir zu. Es mangelt nicht an Events in Europa, wir haben eher zu viele davon. Der Unterschied bei Deep Tech Momentum ist, dass wir kein klassisches Konferenzformat sind, sondern ein Marktplatz. Was heißt das konkret? Wir bringen nicht einfach Leute zusammen, sondern orchestrieren konkrete Interaktionen zwischen Start-ups, Corporates und Investor*innen. Dabei verfolgen wir das klare Ziel, Deals, Partnerschaften und Deployment zu schaffen.

Bei Deep Tech Momentum kommen über 3.000 Senior Entscheider*innen zusammen. Über den Marktplatz wurden bereits mehr als 500 Millionen Euro an Investitionen und hunderte Partnerschaften angestoßen. Unser Ziel bis 2030 ist es, 100 Milliarden Euro zusätzliche DeepTech-Investitionen zu mobilisieren und 10.000 Partnerschaften zwischen Start-ups und Industrie zu ermöglichen.

Ein Beispiel ist unser Guardian Program. Dort bringen wir die Top 300 Senior Innovation Leaders aus führenden Unternehmen gezielt mit vorqualifizierten DeepTech-Start-ups zusammen, also mit Unternehmen, die echte Budgets, konkrete Anwendungsfälle und Entscheidungsmandate mitbringen. Damit packen wir aus meiner Sicht das Kernproblem Europas an: Wir verschaffen Zugang zu ersten Kunden und realen Anwendungen.

StartingUp: Durch langsames Wachstum entsteht ein Druck auf Gründer*innen, in die USA auszuweichen. Dort lockt der Markt gezielt mit Milliarden-Subventionen und schnellem Kapital. Was entgegnest du einem DeepTech-Gründer, der heute zu dir sagt: „Herr Schilling, Europa ist nett für die Forschung, aber um ein Einhorn zu bauen, muss ich sofort in die USA?“

Martin Schilling: Ich würde niemandem pauschal davon abraten, in die USA zu gehen. Für viele Modelle ist das absolut sinnvoll, gerade wenn es um Kapital und Marktskalierung geht. Aber ich würde zwei Dinge entgegnen. Erstens: Europa ist kein schlechter Ort, um ein DeepTech-Unternehmen zu bauen. Wir haben exzellente Forschung, starke Industriepartner und zunehmend auch Kapital. Zweitens – und wichtiger: Der Engpass ist oft nicht der Standort, sondern die Geschwindigkeit, mit der man Kommerzialisierung erreicht. Wenn ein Start-up es schafft, früh echte Kunden zu gewinnen, Piloten zu fahren und Umsatz aufzubauen, dann wird Kapital folgen, auch in Europa. Mit Deep Tech Momentum möchten wir den Weg von Technologie zur Anwendung beschleunigen. Denn es geht nicht um Europa vs. USA. Es geht darum, ob ein Unternehmen es schafft, aus Technologie ein funktionierendes Geschäft zu machen.

Danke, Martin Schilling, für die spannenden Insights

Das Interview führte StartingUp-Chefredakteur Hans Luthardt

Durchatmen in der KI-Ära: HR-Tech-Start-up Regulate sammelt 1,4 Mio. Euro ein

Ein neues B2B-Tool will die mentale Fitness in Unternehmen messbar machen. Hinter dem 2024 von Peter van Woerkum und Paul Laechelin gegründeten Münchner Breathwork-Start-up Regulate stehen prominente Szene-Köpfe. Doch kann eine App das grundlegende Problem struktureller Überlastung lösen?

Die Arbeitswelt verdichtet sich zusehends. Inmitten geopolitischer und wirtschaftlicher Unsicherheiten wird künstliche Intelligenz (KI) in alle Lebensbereiche integriert, was das Arbeitstempo spürbar beschleunigt. In diesem Spannungsfeld positioniert sich das Münchner Start-up Regulate. Das Unternehmen hat nun eine Seed-Finanzierungsrunde in Höhe von 1,4 Millionen Euro abgeschlossen.

Angeführt wird die Runde vom Impact-Investor 4impact.vc. Zu den Business Angels zählen zudem bekannte Namen der deutschen Startup-Szene, darunter Hanno Renner (Co-Founder & CEO, Personio), Mike Wax (Co-Founder, Forto), Marlena Hien (Co-Founder, Bears with Benefits) und Felix Haas (10x Group, Bits & Pretzels, IDnow).

Die Köpfe und die Historie

Hinter Regulate stehen CEO Peter van Woerkum und Paul Laechelin, die das Unternehmen im Jahr 2024 gründeten.

- Peter van Woerkum: Der Gründer ist ein zertifizierter Breathwork- und Executive-Coach, der auf über zehn Jahre Erfahrung in der C-Level-Beratung zurückblickt.

- Paul Laechelin: Als ehemaliger Product Lead für die BMW App bringt er die notwendige technische Expertise mit, um das Produkt für den Enterprise-Einsatz zu skalieren.

- Wissenschaftliches Fundament: Die inhaltliche Entwicklung der App erfolgte in Partnerschaft mit Prof. Dr. Hottenrott von der Martin-Luther-Universität Halle-Wittenberg. Die angebotenen Methoden basieren zudem auf Forschungen der Harvard Medical School und Stanford Medicine.

Das Geschäftsmodell: Präzision statt Gießkanne

Regulate grenzt sich bewusst von herkömmlichen Wellness-Apps ab. Anstatt allgemeine Meditationsübungen bereitzustellen, die in firmeninternen Benefit-Portalen oft ungenutzt bleiben, zielt die Plattform darauf ab, im passenden Moment die richtige Intervention anzubieten.

- Contextual Intelligence: Die App verknüpft sich mit Wearables und den digitalen Arbeitssystemen der Nutzer.

- On-Demand-Tool: Durch das Auslesen physiologischer Signale und die Analyse der Arbeitsstruktur werden personalisierte Atemübungen (Dauer: 90 Sekunden bis 60 Minuten) vorgeschlagen. Dies kann ein Fokus-Protokoll vor einem wichtigen Meeting oder eine Übung zur Beruhigung nach einer intensiven Diskussion sein.

- HR-Dashboard: Arbeitgeber erhalten aggregierte Dashboards, die HR- und Führungsteams Einblicke in Nutzungsmuster und Team-Resilienz geben, ohne die Privatsphäre des Einzelnen zu kompromittieren.

Das Geschäftsmodell stößt auf Resonanz: Innerhalb von weniger als zwölf Monaten wurden über 50.000 Sessions in der App absolviert. Die Enterprise-Pipeline umfasst ein potenzielles Volumen von über 9 Millionen Euro Annual Recurring Revenue (ARR). Zu den Kunden gehören unter anderem die Raiffeisen Bank International, Personio und Vattenfall. Mit dem neuen Kapital will Regulate das Wachstum beschleunigen, die Produktfunktionen vertiefen, Live-Formate ausbauen und europaweit expandieren.

Der Markt: Wachstumsdruck trifft auf Regulatorik

Regulate agiert in einem enormen Markt. Der globale Bereich für Stressmanagement am Arbeitsplatz wurde im Jahr 2023 auf 10,6 Milliarden US-Dollar geschätzt und wächst jährlich um 7,7 Prozent.

- Laut dem „State of the Global Workplace“ Report 2026 von Gallup gibt weltweit nur jede(r) dritte Arbeitnehmer*in an, am Arbeitsplatz zu „florieren“.

- Diese mangelnde Mitarbeiter*innenbindung kostet die Weltwirtschaft schätzungsweise 10 Billionen US-Dollar an ungenutzter Produktivität pro Jahr.

- Die Weltgesundheitsorganisation (WHO) bezifferte in einer Analyse von 2024 die zusätzlichen Kosten durch arbeitsplatzbedingte Angstzustände und Depressionen auf jährlich 1 Billion US-Dollar durch Produktionsausfälle.

Während in den USA vor allem direkte Gesundheitskosten die Arbeitgeberprogramme antreiben, wird der europäische Markt maßgeblich durch rechtliche Verpflichtungen geprägt. Die EU-Richtlinie zur Nachhaltigkeitsberichterstattung (CSRD) – seit Januar 2024 in Kraft – und die EU-Richtlinie zur Vereinbarkeit von Beruf und Privatleben zwingen Unternehmen zu mehr Transparenz und Berichterstattung beim Wohlbefinden der Belegschaft.

Unsere Einordnung: Heilsbringer oder Symptombekämpfung?

Aus Gründer*innen- und Investor*innensicht ist die Positionierung von Regulate strategisch klug. Der B2C-Markt für Achtsamkeit ist hochkompetitiv. Durch den strikten Fokus auf den B2B-Enterprise-Bereich und die nahtlose Integration in den Arbeitsalltag schafft Regulate eine starke Differenzierung. Besonders clever ist die Nutzung der europäischen CSRD-Richtlinie als Vertriebshebel: Unternehmen müssen Wohlbefinden reporten, Regulate liefert das passende aggregierte Dashboard direkt mit.

Trotzdem muss sich das Modell kritischen Fragen stellen:

- Symptombehandlung vs. Ursachenbekämpfung: Eine App kann strukturelle Überlastung durch Personalmangel, fehlendes Management oder toxische Unternehmenskulturen nicht lösen. Es besteht die Gefahr des „Wellbeing-Washings“, bei dem Unternehmen die Verantwortung für Stressbewältigung auf das Individuum abwälzen. CEO Peter van Woerkum betont zwar, dass die Plattform „keine weitere Stressquelle“ hinzufügen soll, doch in stark verdichteten Arbeitsumgebungen kann selbst ein technischer Push-Reminder zur Atemübung als belastend wahrgenommen werden.

- Datenschutz und Vertrauen: Die Koppelung physiologischer Wearable-Daten an ein vom Arbeitgeber finanziertes Dashboard betritt eine sensible Linie. Auch wenn Regulate betont, die Daten streng zu aggregieren, ist die Auswertung von Stressparametern am Arbeitsplatz – gerade in DACH-Unternehmen mit starken Betriebsräten – ein Terrain, das maximales Vertrauen der Belegschaft erfordert.

Fazit

Regulate hat erkannt, dass Corporate Health in Zukunft messbar und direkt in den Arbeitsalltag integriert sein muss. Kann das Start-up beweisen, dass seine Dashboards den Unternehmen helfen, Arbeitsbedingungen datenbasiert und strukturell zu verbessern, steht dem europaweiten Rollout kaum etwas im Wege.

Von Streaming bis Gaming – Diese Branchen profitieren vom digitalen Nutzerverhalten

Wie On-Demand-Modelle Branchen prägen und welche Erfolgsfaktoren Gründer jetzt kennen müssen.

Inhalte, Dienstleistungen und Unterhaltung werden zunehmend flexibel, mobil und individuell konsumiert. Während früher feste Zeiten und physische Angebote dominierten, stehen heute On-Demand-Modelle im Mittelpunkt. Diese Entwicklung wirkt sich nicht nur auf einzelne Produkte aus, sondern prägt ganze Branchen und schafft neue wirtschaftliche Dynamiken. Insbesondere digitale Geschäftsmodelle profitieren von der steigenden Erwartung an Verfügbarkeit, Geschwindigkeit und Personalisierung.

Digitales Nutzerverhalten im Wandel

Die Verschiebung der Nutzungsgewohnheiten von stationären Desktop-Lösungen hin zu mobilen Endgeräten ist der stärkste Treiber der aktuellen Digitalökonomie. On-Demand ist zum Standard geworden: Ob Content, Services oder Unterhaltung – die Erwartungshaltung der Konsumenten ist geprägt von sofortiger Verfügbarkeit und einer hohen Passgenauigkeit durch Personalisierung.

- Inhalte jederzeit abrufbar: Die zeitliche Entkopplung von linearen Sendeplänen oder Öffnungszeiten.

- Omnichannel-Nutzung: Ein nahtloser Übergang zwischen Smartphone, Tablet, Smart-TV und Laptop.

- Komfort als Zahlungsargument: Eine wachsende Bereitschaft, für Zeitersparnis und einfache Bedienbarkeit Abonnements abzuschließen.

Streaming als Vorreiter der digitalen Transformation

Streaming-Dienste gelten als eines der prägendsten Beispiele für die Anpassung an modernes Nutzerverhalten. Klassische Medienformate wurden durch Plattformen ersetzt, die Inhalte jederzeit zugänglich machen. Gleichzeitig haben sich abonnementbasierte Modelle etabliert, die stabile und planbare Einnahmen ermöglichen.

Ein zentraler Erfolgsfaktor liegt in der Nutzung von Daten. Algorithmen analysieren das Verhalten der Nutzer und liefern personalisierte Empfehlungen, wodurch die Verweildauer und Kundenbindung gesteigert werden. Für Unternehmen ergibt sich daraus ein skalierbares Modell, das sich international ausrollen lässt und kontinuierlich optimiert werden kann. Die Grenzkosten pro neuem Nutzer sind minimal. Eine starke Kundenbindung erfolgt hier primär durch exklusiven Content und ein personalisiertes Interface.

In diesem Bereich steht allerdings eine Wende bevor. Durch die große Akzeptanz und Nachfrage sind zahlreiche Angebote und dadurch ein fragmentierter Markt entstanden. Mehrere Abos pro Haushalt sind die Regel und Nutzer wünschen sich zunehmend eine Bündelung.

Gaming und interaktive Unterhaltung auf dem Vormarsch

Gaming hat sich von einer Nische zu einem der weltweit größten digitalen Märkte entwickelt und übertrifft in den Umsätzen längst die Film- und Musikindustrie zusammen. Besonders entscheidend ist hier der soziale Aspekt: Community-Building innerhalb der Spielewelten macht Gaming zu einem sozialen Netzwerk. Der Übergang zu Live-Events und Multiplayer-Erlebnissen schafft eine emotionale Bindung, die weit über das reine Konsumieren hinausgeht.

Gleichzeitig verschiebt sich der Fokus von einmaligen Käufen hin zu kontinuierlichen Einnahmequellen, etwa durch In-Game-Käufe oder abonnementbasierte Modelle. Diese Entwicklung zeigt, wie stark Nutzererlebnisse und soziale Komponenten den Erfolg digitaler Angebote beeinflussen.

iGaming als Teil der digitalen Entertainment-Ökonomie

Innerhalb der digitalen Unterhaltungslandschaft nimmt auch der iGaming-Bereich eine besondere Rolle ein. Dieser Sektor profitiert in ähnlicher Weise von technologischen Entwicklungen wie Streaming und Gaming, insbesondere durch mobile Nutzung, intuitive Benutzeroberflächen und schnelle Transaktionsmöglichkeiten.

Die Plattformen sind darauf ausgelegt, ein möglichst reibungsloses und immersives Nutzererlebnis zu bieten. Online Casino Schweiz präsentiert eine klare Strukturierung unterschiedlicher Games sortiert nach Themen oder Anbietern. Above the fold finden Nutzer Infos zu aktuellen Top-Gewinnern, Verlosungs-Aktionen oder neuen Titeln. Die Kombination aus Gamification-Elementen, internationaler Skalierbarkeit und datenbasierter Optimierung macht diesen Markt aus wirtschaftlicher Perspektive besonders interessant.

Typische Merkmale dieser Branche sind:

- hohe Nutzerbindung durch spielerische Elemente

- globale Ausrichtung digitaler Plattformen

- kontinuierliche Anpassung durch Nutzerdaten

Wirtschaftlichkeit und Transferpotenzial

Die Branche zeichnet sich durch überdurchschnittlich hohe operative Margen aus, da nach der initialen Entwicklung der Plattform und der Integration von Content die Skalierungskosten gering bleiben. Während Marketing- und Lizenzkosten substanziell sind, ermöglichen automatisierte Prozesse in der Kundenverwaltung und Zahlungsabwicklung eine hohe Profitabilität.

Diese Effizienz lässt sich auf andere digitale Angebote übertragen: Das Prinzip der Mikro-Interaktionen und die sofortige Belohnung (Instant Gratification) sind Mechanismen, die auch im E-Commerce oder in Produktivitäts-Apps die Conversion-Rate steigern. Wer lernt, die im iGaming perfektionierten Methoden der Datenanalyse und Echtzeit-Personalisierung zu nutzen, kann die Kundenbindung in nahezu jedem digitalen Geschäftsmodell signifikant erhöhen.

Was Gründer daraus lernen können

Die Analyse erfolgreicher digitaler Branchen zeigt klare Muster. Im Mittelpunkt steht nicht die Technologie selbst, sondern deren Anwendung im Kontext realer Nutzerbedürfnisse. Plattformdenken, Datenanalyse und eine konsequente Ausrichtung auf Benutzerfreundlichkeit sind zentrale Erfolgsfaktoren.

Konkrete Impulse:

- Verhalten statt Produkt: Geschäftsmodelle sollten dort ansetzen, wo Nutzer bereits Zeit verbringen oder Reibungsverluste erleben.

- Iteration: Schnelles Testing von Funktionen (MVP-Ansatz) ermöglicht es, am Puls der Zielgruppe zu bleiben.

- Mobile-First-Denkweise: Jede Lösung muss primär auf dem kleinsten Bildschirm perfekt funktionieren.

- Entwicklung skalierbarer Plattformlösungen

Das digitale Nutzerverhalten entwickelt sich dynamisch weiter und beeinflusst zahlreiche Branchen nachhaltig. Unternehmen, die diese Veränderungen frühzeitig erkennen und in ihre Strategien integrieren, sichern sich entscheidende Wettbewerbsvorteile. Besonders erfolgreich sind Modelle, die Flexibilität, Personalisierung, einfache Zugänglichkeit und die Einbindung in starke App-Ökosysteme miteinander verbinden. In einer zunehmend digitalen Wirtschaft entstehen neue Chancen vor allem dort, wo technologische Möglichkeiten auf veränderte Erwartungen treffen.

Weitere Gewinner des Nutzerwandels

Neben Unterhaltung und Gaming profitieren auch andere Branchen vom veränderten Verhalten. Besonders deutlich wird dies in Bereichen, die auf flexible Nutzung und personalisierte Angebote setzen.

Dazu zählen unter anderem:

- E-Learning-Plattformen, die ortsunabhängiges Lernen ermöglichen

- Fitness- und Gesundheits-Apps, die individuelle Trainingspläne bieten

- Fintech-Lösungen, die schnelle und unkomplizierte Zahlungsprozesse unterstützen

Gemeinsam ist diesen Geschäftsmodellen eine starke Nutzerzentrierung. Sie bieten Lösungen, die sich nahtlos in den Alltag integrieren lassen und dabei individuelle Bedürfnisse berücksichtigen.

Was Gründer daraus lernen können

Der entscheidende Erfolgsfaktor in der digitalen Ökonomie ist die radikale Nutzerzentrierung. Erfolgreiche Unternehmen denken nicht mehr in isolierten Produkten, sondern in Plattformen, die ein Problem ganzheitlich lösen. Die Bedeutung von Datenanalyse zur stetigen Verbesserung der UX kann dabei nicht überschätzt werden.

Die Verfestigung digitaler Gewohnheiten ist ein unumkehrbarer Prozess. Neue Märkte werden dort entstehen, wo technologische Möglichkeiten auf neue menschliche Bedürfnisse treffen. Die größten Chancen liegen für Gründer und etablierte Unternehmen dort, wo sich das Nutzerverhalten schneller wandelt als die bestehenden, oft noch trägen Angebote am Markt.

ENVIOTECH sichert sich Millionenfinanzierung für intelligente öffentliche Straßenbeleuchtung

Das Frankfurter Start-up ENVIOTECH rund um Adrian Rhaese, Linh Pham, Dustin Arnold und Peter Kletsko hat eine Pre-Seed-Runde in Höhe von einer Million Euro abgeschlossen, um öffentliche Straßenbeleuchtung intelligent nachzurüsten. Doch der Markt für kommunale Infrastruktur ist hart umkämpft und bürokratisch. Kann das junge Team die öffentlichen Verwaltungen überzeugen?

Es ist ein klassisches Gründer*innen-Narrativ: Aus einem persönlichen Schmerzpunkt entsteht eine Geschäftsidee. Im Fall von ENVIOTECH war es ein Fahrradunfall. Der beste Freund von Mitgründer Adrian Rhaese verunglückte, weil in einer deutschen Stadt die Straßenlaternen aufgrund gestiegener Stromkosten abgeschaltet worden waren. Dieser Vorfall weckte bei Rhaese das Unverständnis darüber, dass in einem wirtschaftlich starken Land ausgerechnet an der Sicherheit gespart wird – und legte den Grundstein für das Smart-City-Start-up.

Bye-bye Bankenturm: Der Sprung ins kalte Wasser

Anstatt ihren als sicher geltenden Karriereweg fortzusetzen, verließen Adrian Rhaese und Mitgründerin Linh Pham ihre Positionen als duale Studierende bei der Deutschen Bank. Sie entschieden sich bewusst für das unternehmerische Risiko, um reale Infrastrukturprobleme zu lösen.

Eine erste Bestätigung für diesen Schritt erhielt das junge Team durch die Aufnahme in das EWOR Fellowship. Daniel Dippold, Gründer und CEO von EWOR, bescheinigt dem Team den richtigen Fokus: „Unspektakuläre Infrastruktur gewinnt langfristig fast immer. Straßenbeleuchtung ist nicht glamourös, aber sie ist allgegenwärtig, unverzichtbar und aus keiner Stadt wegzudenken.“

Plug-and-Play am Lichtmast: Das 15-Minuten-Update

Die technische Lösung von ENVIOTECH setzt auf Pragmatismus: Anstatt Laternen kostenintensiv komplett auszutauschen, bietet das Unternehmen ein Retrofit-System an. Das Produkt soll sich laut Unternehmensangaben in unter 15 Minuten in bestehende Leuchten integrieren lassen.

Die nachgerüsteten Laternen kommunizieren als Mesh-Netzwerk miteinander und dimmen das Licht KI-gesteuert und bedarfsgerecht anhand von Bewegungserkennung. Das Startup verspricht dadurch Energieeinsparungen von bis zu 80 Prozent; gleichzeitig soll die öffentliche Sicherheit erhöht werden. Kommunen erhalten so die Möglichkeit, ihre Beleuchtung zentral zu steuern und in Echtzeit zu überwachen.

Um das Konzept in die Fläche zu tragen, konnte ENVIOTECH nun eine Pre-Seed-Finanzierung in Höhe von 1 Million Euro einsammeln. Angeführt wird die Runde passenderweise vom ehemaligen Co-CEO der Deutschen Bank, Jürgen Fitschen. Ergänzt wird das Konsortium durch Ex-MAN-CEO Joachim Drees, Alexander Eyhorn (Gründer von Bidirex) und Danilo Jovicic-Albrecht (Mitgründer des auf Kommunen spezialisierten Startups Vialytics). Mit dem frischen Kapital sollen Pilotprojekte forciert und das Technologieportfolio weiterentwickelt werden.

Der Endgegner heißt B2G-Markt: David gegen die Industrie-Goliaths

So einleuchtend die Technologie klingt, das Geschäftsmodell von ENVIOTECH steht vor gewaltigen Hürden. Der B2G-Markt (Business-to-Government) ist für Start-ups extrem schwierig. Kommunen, die ENVIOTECHs primäre Zielgruppe darstellen, arbeiten mit langen Budgetzyklen und streng regulierten öffentlichen Ausschreibungsverfahren. Bis ein Pilotprojekt zu einem flächendeckenden Rollout führt, vergehen oft Jahre.

Darüber hinaus agiert das Start-up nicht im luftleeren Raum. Der Smart-Lighting-Markt wird von Industriegiganten wie Signify oder Schréder dominiert, die längst eigene IoT-Lichtsteuerungssysteme anbieten. Auch andere Start-ups wie Tvilight oder Icegateway haben das Potenzial vernetzter Straßenbeleuchtung erkannt.

Der entscheidende USP von ENVIOTECH muss daher in der Geschwindigkeit und Einfachheit liegen: Gelingt die versprochene rasante Installation und können Kommunen die Lösung ohne massive Tiefbauarbeiten testen, hat das Start-up einen echten Wettbewerbsvorteil. Besonders klug ist hierbei die Auswahl der Investor*innen: Mit Drees und Jovicic-Albrecht hat das Gründerduo Köpfe an Bord geholt, die wissen, wie man komplexe Produkte an die öffentliche Hand verkauft. Schafft es ENVIOTECH, den extrem zähen Vertriebszyklus öffentlicher Verwaltungen zu knacken, könnte das Unternehmen zu einem hochrentablen Hidden Champion heranwachsen.

Primogene: 4,1 Mio. Euro für den Muttermilch-Code – Deep-Tech-Innovation oder riskantes Unterfangen?

Das Leipziger BioTech-Start-up Primogene hat eine Seed-Finanzierung in Höhe von 4,1 Mio. Euro eingesammelt, um komplexe bioaktive Moleküle im industriellen Maßstab auf den Markt zu bringen.

Während die Unternehmenskommunikation den Durchbruch einer neuen Plattformtechnologie feiert, zeigt ein genauerer Blick auf den globalen Markt für humane Milcholigosaccharide (HMOs) ein Haifischbecken voller multinationaler Konzerne. Eine kritische Analyse des Geschäftsmodells, der Gründer*innen und des Wettbewerbs.

DeepTech Made in Leipzig

Hinter Primogene stehen Dr.-Ing. Reza Mahour (CEO), Valerian Grote und Linda Karger (COO), die das Unternehmen 2023 in Leipzig gründeten. Die Zusammensetzung des Teams vereint technologische und wissenschaftliche Expertise, um die ehrgeizige Vision einer industriellen Enzym-Produktion umzusetzen. Die aktuelle, 4,1 Millionen Euro starke Seed-Runde wird vom High-Tech Gründerfonds (HTGF) angeführt. Zum Investoren-Konsortium gehören außerdem der Technologiegründerfonds Sachsen (TGFS), better ventures, die Sächsische Beteiligungsgesellschaft (SBG), die Golzern Holding GmbH, die FS Life Science Investment GmbH sowie Dr. Marc Struhalla, Gründer und CEO der c-LEcta GmbH. Der Kapitaleinsatz ist klar definiert: Die neuen Mittel fließen in den Ausbau des IP-Portfolios, die Erweiterung der Produktionskapazitäten in Leipzig und in strategische Partnerschaften.

Das Modell im Stresstest: Die Kostenfalle der Enzyme

Primogene hat eine enzymatische Plattformtechnologie entwickelt, um Inhaltsstoffe zu produzieren, die identisch zu natürlichen Molekülen sind – nachhaltig und kosteneffizient. Im Zentrum stehen dabei komplexe humane Milcholigosaccharide (HMOs) wie Disialyllacto-N-Tetraose (DSLNT) und Difucosyllacto-N-Tetraose I (LNDFH I). Laut Primogene verursachen etablierte fermentative Herstellungsverfahren erhebliche Kosten und stoßen bei der Produktion derartiger hochkomplexer Moleküle an ihre Grenzen.

Der Lackmustest: Die Prämisse, dass enzymatische Verfahren in der Massenproduktion überlegen sind, birgt in der Praxis massive Hürden. Die Entwicklung und wirtschaftliche Produktion der benötigten Enzyme selbst ist extrem kapitalintensiv. Dass das Start-up den gesamten Prozess – von der Enzymentwicklung über die Produktion und Biotransformation bis zur Aufreinigung – komplett am eigenen Unternehmensstandort in Leipzig abbilden will, ist ein ambitionierter, aber riskanter Schritt. Der Aufbau eigener Produktionsanlagen für komplexe BioTech-Prozesse führt oft zu einer enorm hohen Kapitalverbrennungsrate (Burn Rate).

Erste kommerzielle Meilensteine dämpfen dieses Risiko jedoch: Erste Inhaltsstoffe für Kosmetikprodukte wurden mit Kooperationspartnern entwickelt und sind bereits kommerziell erhältlich. Auch pharmazeutische Rohstoffe befinden sich aktuell im Test bei Kund*innen. Zudem erforscht das Unternehmen in Zusammenarbeit mit dem Fraunhofer-Institut für Zelltherapie und Immunologie (IZI) in Leipzig das Potenzial seiner Inhaltsstoffe zur Prävention von Infektionskrankheiten.

Im Haifischbecken: Auf Kollisionskurs mit den Lebensmittel-Riesen

Der Zielmarkt ist hochattraktiv: Der globale HMO-Markt wächst jährlich um etwa 18 bis 20 Prozent, und über 65 Prozent der im Jahr 2023 neu eingeführten Säuglingsnahrungsprodukte enthielten mindestens ein HMO. Neben der Säuglingsernährung bedient Primogene auch Märkte wie die Darmgesundheit bei Erwachsenen, die Gedächtnisverbesserung im Alter sowie funktionale Inhaltsstoffe für Körperpflege und pharmazeutische Rohstoffe.

Das Leipziger Team trifft in der Nahrungsmittelindustrie jedoch auf einen extrem konsolidierten Markt, der von Milliarden-Konzernen dominiert wird. Einer der größten B2B-Zulieferer für Säuglingsnahrung weltweit ist DSM-Firmenich (mit der übernommenen Sparte Glycom), der den Markt durch gigantische Größenvorteile (Economies of Scale) in der Fermentation beherrscht. Auch Chr. Hansen (Jennewein), ein Pionier in der mikrobiellen HMO-Synthese, stellt mit seiner extrem tiefen Integration bei Lebensmittelriesen einen massiven Konkurrenten dar. Auf der Abnehmerseite agieren Endkonsument*innen-Giganten und Branchenführer wie Nestlé und Abbott, bei denen für einen neuen Zulieferer von Inhaltsstoffen extrem hohe regulatorische und volumenbasierte Hürden bestehen.

Primogenes strategische Nische: Ein Preiskampf bei einfach strukturierten Standard-HMOs gegen die großen Fermentations-Player wäre für ein Start-up kaum zu gewinnen. Primogenes entscheidender Wettbewerbsvorteil liegt jedoch in der Komplexität. Die industrielle Produktion von Molekülen wie DSLNT – das laut klinischen Studien signifikante gesundheitliche Vorteile speziell für Frühgeborene bietet – war bislang schlicht nicht möglich. Wenn Primogene hier durch sein starkes Patentportfolio die technologische Lücke schließt, umgeht das Unternehmen den harten Konkurrenzkampf im Massenmarkt.

Unser Fazit: Hohes Risiko, riesiger Hebel

Primogene ist kein schlankes Software-Projekt, sondern waschechtes DeepTech. Das bedeutet: Hohe regulatorische Hürden, langer Atem in der Forschung und massive Kapitalanforderungen. Die Seed-Finanzierung in Höhe von 4,1 Millionen Euro ist ein starker Vertrauensbeweis erfahrener Investoren, wird für den Anlagenbau und die Skalierung der Leipziger Produktion auf Dauer jedoch kaum ausreichen. Primogene muss nun rasch beweisen, dass die enzymatische Synthese nicht nur technologisch überlegen, sondern auch unter realen industriellen Kostendrücken skalierbar ist. Gelingt dieser Proof of Concept, hält das Start-up den Schlüssel zu einer neuen Generation komplexer, bioaktiver Moleküle in der Hand.

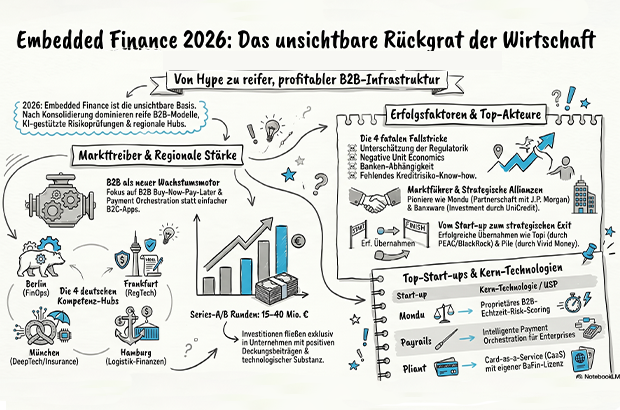

Embedded-Finance-Start-up-Report 2026

Der unsichtbare Bankensektor: Wie Embedded Finance und die dazugehörigen Start-ups die Wirtschaft des Jahres 2026 prägen.

Einst war es das große Versprechen für eine Handvoll hipper Neobanken, heute ist es das unsichtbare Rückgrat der europäischen Wirtschaft: Embedded Finance. Im Jahr 2026 wird das Marktwachstum längst nicht mehr von der fixen Idee isolierter Bank-Apps dominiert, denn jedes zukunftsorientierte Unternehmen ist mittlerweile selbst zu einem/einer Finanzdienstleister*in geworden. Ob Software-as-a-Service-Anbieter*in, Logistik-Plattform oder Marktplatz – die nahtlose Integration von Zahlungen, Krediten und Versicherungen in nicht-finanzielle Kund*innenreisen ist das neue Paradigma.

Dieser Report beleuchtet eine Branche, die den „Sturm der Konsolidierung“ überlebt hat und nun mit reifen Geschäftsmodellen und echten Profiten die Architektur der modernen Wirtschaft neu programmiert.

Vom Hype zur fundamentalen Reife

Nach den massiven Zinsanpassungen und regulatorischen Aufräumarbeiten der Jahre 2023 und 2024 zeichnet der Embedded-Finance-Markt heute ein Bild robuster Reife. Renommierte Analystenhäuser wie Bain & Company und Dealroom haben diese Entwicklung früh vorgezeichnet: Der globale Markt für Embedded-Finance-Dienstleistungen hat sich in ein Multimilliarden-Segment verwandelt, dessen europäisches Transaktionsvolumen mittlerweile signifikante Teile des digitalen B2B- und B2C-Handels stützt. Der technologische Haupttreiber dieser neuen Ära ist unbestreitbar die künstliche Intelligenz, genauer gesagt proprietäre Machine-Learning-Modelle, die Risikobewertungen in Millisekunden durchführen und Transaktionsströme dynamisch optimieren. Investor*innen honorieren diese technologische Tiefe: Wir sehen heute höchst realistische Series-A- und Series-B-Runden im Bereich von 15 bis 40 Millionen Euro für Start-ups, die nachweislich positive Deckungsbeiträge aufweisen. Es fließt wieder signifikant Kapital, doch es fließt exklusiv in Substanz und Skalierbarkeit, nicht mehr in reines Marketing.

Die neuen Treiber: B2B, Vertikalisierung und Orchestrierung

Wenn man über das Offensichtliche wie einfache White-Label-Kreditkarten hinausblickt, dominieren im Jahr 2026 drei spezifische Sub-Sektoren den Markt. Allen voran steht B2B Buy-Now-Pay-Later, eine Disziplin, die das traditionelle, schwerfällige Factoring abgelöst hat und nun direkt in B2B-Checkouts und Beschaffungsnetzwerke integriert ist. Ein weiterer massiver Treiber ist die sogenannte Payment Orchestration für vertikale SaaS-Lösungen. Hier werden komplexe, branchenspezifische Zahlungsflüsse – etwa im Handwerk oder in der Gastronomie – automatisiert im Hintergrund abgewickelt. Zuletzt etabliert sich Embedded Insurance zunehmend im Industriekontext, wo Maschinen nicht mehr nur geleast, sondern im selben Atemzug transaktionsbasiert versichert werden. Pioniere wie die Berliner Mondu oder auch europäische Schwergewichte wie Swan haben den Weg für diese hochspezialisierten Infrastruktur-Layer geebnet und gezeigt, wie tiefgreifend diese Geschäftsmodelle in die Wertschöpfungsketten der Realwirtschaft eingreifen.

Die Lektionen der BaaS-Krise

Doch dieser Reifegrad wurde teuer erkauft. Der Beinahe-Kollaps des britischen Banking-as-a-Service-Pioniers Railsr und die drastischen BaFin-Sonderprüfungen samt Wachstumsbeschränkungen bei etablierten deutschen Playern wie Solaris in den Jahren zuvor haben den Markt fundamental erschüttert. Der Traum, Finanzdienstleistungen wie einfache Legosteine zusammenzustecken, kollidierte brutal mit der harten Realität des Bankwesens.

Aus diesen gescheiterten Hoffnungen lassen sich für heutige Gründer*innen vier konkrete, fatale Fallstricke ableiten. Der erste und wichtigste ist die eklatante Unterschätzung der Regulatorik; Compliance lässt sich nicht auslagern, und Aufsichtsbehörden dulden keine agilen Versuch-und-Irrtum-Prozesse bei der Geldwäscheprävention. Der zweite Fallstrick ist die Falle der negativen Unit Economics im B2C-Sektor, wo exorbitante Kund*innenakquisitionskosten oft nur durch kontinuierliches VC-Geld gedeckt wurden. Drittens das Klumpenrisiko der Abhängigkeit von einer einzigen Partnerbank, deren Ausfall das eigene Start-up über Nacht handlungsunfähig macht. Und viertens die Fehlannahme, dass Technologie allein ausreicht; wer heute kein tiefes Verständnis für klassisches Bilanzstruktur- und Kreditrisikomanagement mitbringt, scheitert unweigerlich.

Das deutsche Netzwerk: Die Schmieden der Infrastruktur

Deutschland hat sich in dieser Konsolidierungsphase als einer der resilientesten Standorte in Europa bewiesen, getragen von vier essenziellen Hubs. Berlin verteidigt dabei seinen Status als unangefochtene Hauptstadt für FinOps und B2B-Zahlungsinfrastruktur, massiv befeuert durch die Talent-Pipelines der TU Berlin sowie das dichte Netzwerk an Serial Entrepreneurs aus der N26- und SumUp-Schule. Frankfurt am Main bildet den unverzichtbaren regulatorischen Gegenpol; hier, im Schatten von EZB und BaFin, entstehen im Umfeld des TechQuartiers und der Frankfurt School of Finance and Management jene Start-ups, die komplexe Compliance- und Treasury-Architekturen für Großbanken bauen. München dominiert den Bereich DeepTech und Embedded Insurance im industriellen B2B-Kontext, was auf die herausragende Stellung des Center for Digital Technology and Management (CDTM) und die enge Verzahnung mit der ansässigen Versicherungs- und Automobilindustrie zurückzuführen ist. Hamburg schließlich hat sich als europäischer Hotspot für Trade Finance und in Logistikketten eingebettete Finanzierungen etabliert, gestützt durch die traditionelle Stärke der Hansestadt im globalen Handel.

Investor*innen-Radar

Das Ökosystem der Geldgeber*innen hat sich im Jahr 2026 stark differenziert und professionalisiert. An der Spitze der spezialisierten VCs agieren Fonds wie FinTech Collective und Motive Ventures (hervorgegangen aus der Übernahme des Berliner VCs embedded/capital), die mit tiefem technologischen Verständnis gezielt in Infrastruktur-Layer investieren. Unter den Top-Tier Generalisten ragen Cherry Ventures, Earlybird und Point Nine heraus, die insbesondere Series-A-Runden bei überzeugenden B2B-SaaS-Modellen anführen.

Ein starker Motor sind zudem Corporate VCs und bankennahe Fonds geworden: CommerzVentures, als unabhängiger Player, treibt Themen wie Climate-Fintech massiv voran, während CVCs der Realwirtschaft wie Allianz X und Porsche Ventures strategisch in Start-ups investieren, die sich nahtlos in ihre eigenen vertikalen Ökosysteme einklinken lassen. In der kritischen Frühphase wird der Markt von einer hochgradig vernetzten Gruppe aus Business Angels angetrieben, die nicht nur erstes Kapital, sondern vor allem regulatorisches Know-how und entscheidende Bankennetzwerke einbringen

Die Top Start-ups (Must-Watch)

Für die nachfolgende Liste der Must-Watch-Unternehmen haben wir strikte Kriterien angelegt. Die Auswahl basiert auf nachgewiesener Marktrelevanz durch echte Kund*innenimplementierungen, einem hohen technologischen Reifegrad und einem diversifizierten Ansatz bei der Lösung komplexer Finanzinfrastrukturprobleme. Zudem war ein nachhaltiges Investoren-Vertrauen in den letzten zwölf Monaten ein Schlüsselfaktor. Wir beleuchten hierbei ausschließlich Start-ups mit Hauptsitz in Deutschland, deren Gründung im Jahr 2020 oder später erfolgte, um die wahre nächste Generation der Branche abzubilden.

Banxware

Das 2020 von Miriam Wohlfarth und Jens Röhrborn gegründete Banxware hat sich als Marktführer für Embedded Lending in Deutschland etabliert. Banxware bietet eine White-Label-Lösung, mit der Marktplätze und Zahlungsdienstleister*innen ihren Händler*innen Sofortkredite basierend auf historischen Umsatzdaten anbieten können. Der USP liegt in der extrem schnellen Risikoprüfung und der nahtlosen API-Integration in bestehende Plattformen. Das enorme Vertrauen der Finanzbranche in dieses Modell spiegelt sich massiv auf Investor*innenseite wider: Neben frühen Leadern wie Element Ventures (heute 13books Capital) ist insbesondere der Einstieg der Großbank UniCredit ein Ritterschlag. Die Bank führte nicht nur die Series-A-Runde an, sondern legte Mitte 2025 mit einem weiteren strategischen Millionen-Investment nach, um die europäische Expansion von Banxware gemeinsam voranzutreiben.

Pliant

Im Jahr 2020 von Malte Rau und Fabian Terner aus der Taufe gehoben, definiert Pliant den Markt für B2B-Kreditkarten und Ausgabenmanagement neu. Das B2B-SaaS-Modell kombiniert eine moderne Karteninfrastruktur mit einer tiefen API-basierten Integration in Buchhaltungs- und ERP-Systeme. Der technologische Vorsprung liegt im eigenen Card-as-a-Service-Angebot (CaaS), das anderen B2B-Plattformen den Launch eigener Kreditkartenprogramme ermöglicht. Ein entscheidender Meilenstein war hierfür der Erhalt der eigenen E-Geld-Lizenz der BaFin, die Pliant die nötige regulatorische Unabhängigkeit verleiht. Unterstützt wird Pliant von namhaften Investoren wie SBI Investment, Alstin Capital – und einem Investment des globalen Schwergewichts PayPal Ventures, das das enorme Skalierungspotenzial der Plattform bestätigt.

Mondu

Die Serial Entrepreneurs Malte Huffmann, Philipp Povel und Gil Danziger gründeten Mondu 2021 und revolutionieren damit den B2B-Zahlungsverkehr. Ihr B2B-BNPL-Modell ermöglicht es Geschäftskund*innen, online wie B2C-Kund*innen auf Rechnung oder in Raten zu kaufen, während der Händler sofort sein Geld erhält. Die Kerntechnologie ist ein proprietäres Echtzeit-Risk-Scoring für Firmenkund*innen. Finanziert wurde diese Vision anfangs von Top-Tier-Fonds wie Valar Ventures und Cherry Ventures. Der ultimative Ritterschlag erfolgte jedoch Ende 2025: Neben dem Erhalt der E-Geld-Lizenz sicherte sich Mondu eine 100-Millionen-Euro-Fazilität von J.P. Morgan Payments inklusive einer strategischen Partnerschaft, um die Buy-Now-Pay-Later-Lösung dem europäischen Kund*innen stamm der US-Großbank anzubieten.

Payrails

Gegründet 2021 von Orkhan Abdullayev, Emre Talay und Nicolas Thouzeau, löst Payrails die Herausforderung der Payment Orchestration. Das FinOps-Start-up baut ein intelligentes Betriebssystem für Zahlungen, das Transaktionen für Enterprise-Kund*innen dynamisch über verschiedene Provider routet, um Kosten zu senken und Autorisierungsraten zu maximieren. Die technologische Brillanz dieser Architektur lockte früh Schwergewichte wie Andreessen Horowitz und EQT Ventures an. Im Sommer 2025 zündete Payrails die nächste Stufe: HV Capital führte eine massive Series-A-Runde über 32 Millionen US-Dollar an, bei der auch alle Top-Tier-Altinvestoren erneut mitzogen, um die globale Expansion der Plattform endgültig zu sichern.

Finmid

Die beiden N26-Alumni Max Schertel und Alexander Talkanitsa starteten Finmid 2021 mit der Mission, jede B2B-Plattform zu einer Finanzierungsquelle zu machen. Ihr Geschäftsmodell fokussiert sich auf Embedded B2B Lending, das speziell auf die Anforderungen von Marktplätzen (wie etwa dem Partner Wolt) zugeschnitten ist – ohne dass diese Plattformen eigenes Kapital bereitstellen oder Risiken tragen müssen. Ihr USP ist die radikale Simplifizierung der B2B-Kreditvergabe durch smarte Echtzeit-Datenverknüpfungen. Angetrieben von einer wuchtigen 23-Millionen-Euro-Series-A-Runde, angeführt vom britischen Fonds Blossom Capital und dem Seed-Lead Earlybird, treibt das Start-up seine aggressive europäische Expansion unaufhaltsam voran.

Topi (Exit)

Charlotte Pallua und Estelle Merle brachten Topi 2021 an den Start, um das Hardware-as-a-Service-Modell in den B2B-Bereich zu integrieren. Über die Plattform können B2B-Kund*innen IT-Equipment flexibel mieten, wobei Topi den gesamten Prozess vom Checkout über das Refinancing bis zum Asset-Management abwickelt. Nachdem Topi mit Händler*innen wie Cyberport massiv skalierte und von Top-VCs wie Index Ventures und Creandum finanziert wurde, erfolgte im Sommer 2025 der strategische Exit: Das FinTech wurde von dem internationalen Leasing-Giganten PEAC Solutions (einem BlackRock-Portfoliounternehmen) übernommen, um das innovative B2B-Mietmodell global in dessen gewaltige Finanzierungsinfrastruktur einzugliedern.

Hakuna

Im Bereich Embedded Insurance schlägt das 2021 von Sebastian Jost, Rupert Mayer und Orhan Köroglu gegründete Hakuna neue Wege ein. Das Start-up bietet Händler*innen eine Plattform für Garantieverlängerungen und Produktschutzversicherungen, nahtlos integriert in den Online- und Offline-Checkout. Der USP ist ein völlig neu gedachtes, digitales Schadensmanagement, das die Abwicklung für Endkund*innen radikal vereinfacht. Finanziert von Top-VCs wie Earlybird und Visionaries Club, hat Hakuna mittlerweile den Sprung ins absolute Enterprise-Segment geschafft: Im Jahr 2025 integrierten Branchenriesen wie Vorwerk, STIHL und Mister Spex die Embedded-Technologie des Start-ups, um ihre eigenen, maßgeschneiderten Produktschutzprogramme europaweit zu skalieren.

Pile (Exit)

Jessica Holzbach startete Pile 2022 und pivotierte das Modell nach dem Krypto-Winter erfolgreich zu einem hochspezialisierten Treasury-Angebot für Start-ups. Die B2B-SaaS-Technologie bündelte Konten und automatisierte die Diversifikation von Einlagen zur Risikominimierung. Das Modell erregte schnell Aufmerksamkeit und führte bereits im Sommer 2024 zu einem frühen Exit: Die 2019 gegründete Berliner Neobank Vivid Money übernahm das Start-up, um das eigene Business-Banking-Angebot mit Piles Treasury-Technologie aufzurüsten – ein Paradebeispiel für die rasante Konsolidierung im FinTech-Infrastrukturmarkt.

Internationaler Ausblick & Fazit

Blickt man über die Grenzen Europas hinaus, formen sich 2026 drei gewaltige Makro-Trends, die den deutschen Markt unausweichlich verändern werden. Aus Asien schwappt die Architektur für grenzüberschreitende Echtzeit-Settlements basierend auf regulierten Stablecoins und digitalen Zentralbankwährungen heran, was das traditionelle Korrespondenzbankensystem massiv unter Druck setzt. Die USA hingegen dominieren die Entwicklung der KI-gesteuerten autonomen Finanzen, bei der das Corporate Treasury von Algorithmen gesteuert wird, die ohne menschliches Zutun Liquidität verschieben. Aus Indien lernen wir, wie Identity-as-a-Service untrennbar mit dem Zahlungsverkehr verschmilzt und Betrug nahezu ausmerzt.

Für Gründer*innen und Investor*innen im DACH-Raum bedeutet dies: Der Fokus muss radikal auf Profitabilität, wasserdichter Compliance und extrem stabiler Infrastruktur liegen. Wer heute in Embedded Finance gewinnt, baut keine bunten Apps mehr, sondern die hochkomplexen, unsichtbaren Stahlträger der digitalen Weltwirtschaft.

Tatendrang trifft Struktur – Ist Deutschland wirklich innovationsmüde?

Gründer*innen haben Gestaltungswillen, aber Bürokratie wirkt als tödliche Handbremse. Im Experten-Interview verrät Zukunftsberater und Start-up-Mentor Dr. Jenkis, was sich jetzt ändern muss.

In der öffentlichen Debatte wird Deutschland oft als Land der Bedenkenträger*innen und der bürokratischen Starre gezeichnet. Doch während die Medien über eine allgemeine Verunsicherung berichten, zeigt ein Blick in die Werkstätten und Büros von Gründer*innen und Unternehmer*innen ein anderes Bild: Hier herrscht „Gestaltungslust“ statt Stillstand.

Eine aktuelle Umfrage der ZUKUNFTSWERKE GmbH mit dem Titel „TATENDRANG TRIFFT STRUKTUR: Innovation im Spannungsfeld zwischen Willen und Wirklichkeit“ räumt mit gängigen Klischees auf. Die Ergebnisse belegen, dass der unternehmerische Kern längst auf Aufbruch programmiert ist: 32 Prozent der Befragten treibt der Wille an, die Zukunft aktiv zu gestalten.

Dr. Dirk Jenkis ist Zukunftsberater und Start-up-Mentor sowie der Kopf hinter ZUKUNFTSWERKE und Experte für die Dynamiken zwischen unternehmerischem Willen und strukturellen Rahmenbedingungen. Warum Innovationen oft auf halber Strecke stecken bleiben und warum das Problem weniger in den Köpfen als in den Strukturen liegt, erklärt er im Interview.

Herr Dr. Jenkis, Ihre Studie zeigt: 32 % der Unternehmer*innen wollen Zukunft aktiv gestalten, statt sie nur zu verwalten. Warum klafft die Schere zwischen diesem inneren Tatendrang und der öffentlichen Wahrnehmung einer „lahmenden Wirtschaft“ so weit auseinander?

Dr. Jenkis: Weil wir zwei völlig unterschiedliche Bilder betrachten. Innen sehe ich Unternehmer mit Energie, Ideen und einem klaren Gestaltungswillen. Außen diskutieren wir oft über Symptome: schwaches Wachstum, zähe Prozesse, Unsicherheit. Das Problem ist nicht fehlender Tatendrang. Das Problem ist, dass dieser Tatendrang in einem Umfeld stattfindet, das ihn oftmals ausbremst. Wenn Sie ständig gegen Bürokratie, langsame Verfahren oder unklare Regeln anlaufen, wirkt selbst die dynamischste Organisation irgendwann träge. Die Wirtschaft ist also nicht lahm. Sie läuft nur oft mit angezogener Handbremse.

Mut (27 %) und Neugier (23 %) sind laut Umfrage die wichtigsten Zutaten für Innovation. Warum ist das „Entscheiden ohne vollständige Datenbasis“ heute die wichtigste Kernkompetenz für Gründende?

Dr. Jenkis: Weil die Welt schneller ist als jede Datengrundlage. Wer wartet, bis alles sicher ist, kommt schlicht zu spät. Gründer bewegen sich immer im Ungewissen. Genau dort entsteht Innovation. Mut heißt nicht Leichtsinn, sondern beschreibt die Fähigkeit, mit Unsicherheit produktiv umzugehen.

Und Neugier sorgt dafür, dass man die richtigen Fragen stellt, statt nur auf Antworten zu warten. Die Kombination aus beidem ist entscheidend: neugierig denken, mutig handeln. Wer das beherrscht, hat einen echten Wettbewerbsvorteil.

Ihre Studie weist darauf hin, dass die gefürchtete Risikoaversion oft bei Kapitalgeber*innen und Investor*innen sitzt. Wie pitcht man als Start-up erfolgreich gegen ein Umfeld an, das zwar Innovation fordert, aber offensichtlich Angst vor dem Scheitern hat?

Dr. Jenkis: Indem man Klarheit schafft. Investoren reagieren nicht auf Vision allein, sondern auf nachvollziehbare Logik. Ein guter Pitch verbindet Mut mit Struktur. Er zeigt: Ich weiß, was ich tue, auch wenn ich nicht alles weiß. Gleichzeitig braucht es auf der Investorenseite mehr Bereitschaft, Risiko als Teil von Innovation zu akzeptieren. Kapitel entscheidet mit darüber, wie viel Innovation möglich wird. Wer nur sichere Wetten eingeht, bekommt keine Durchbrüche.

Die größte Bremse ist nicht der mangelnde Wille, sondern fehlende Ressourcen und regulatorische Hürden. Ist der „Innovationsstandort Deutschland“ also eher ein Sanierungsfall der Strukturen als ein Problem der Köpfe?

Dr. Jenkis: Es ist ganz klar ein Strukturthema. Ich habe in den Antworten dieser Studie sehr viel Energie gesehen. Sehr viel Bereitschaft, Verantwortung zu übernehmen und Neues zu schaffen. Was fehlt, sind oft Geschwindigkeit, Verlässlichkeit und Einfachheit im System. Das Gute daran ist aber: Strukturen lassen sich verändern, wesentlich leichter als Mindset. Und genau darin liegt die Chance. Wir müssen nicht erst Motivation erzeugen. Wir müssen die vorhandene Motivation freisetzen und Gründern mehr Steine aus dem Weg räumen.

15 % der Befragten klagen über zu viele Prozesse und zu wenig Freiheitsgrade. Wie bewahren sich Start-ups beim Wachsen ihre Agilität, ohne in die „Konzern-Falle“ zu tappen?

Dr. Jenkis: Die „Konzern-Falle“ entsteht, wenn Prozesse zum Selbstzweck werden. Wachstum braucht Struktur, aber Struktur muss Klarheit schaffen, statt Tempo zu nehmen. Viele Scale-Ups bauen sich schleichend Komplexität auf, die sie später selbst ausbremst. Entscheidend ist, dass Gründer sich mitentwickeln und ihr eigenes System immer wieder hinterfragen. Ohne Widerspruch entsteht schnell eine Echokammer. Agilität bleibt, wenn jemand regelmäßig stört, Fragen stellt und Entscheidungen schärft. Am Ende gilt: Nicht weniger Prozesse machen agil, sondern die richtigen.

77 % der Befragten haben ihr Geschäftsmodell im letzten Jahr grundlegend hinterfragt. Ist eine permanente „positive Paranoia“ heute die einzige Überlebensstrategie?

Dr. Jenkis: Schon 1996 schrieb der Intel-Mitgründer Andy Groove sein Buch mit dem Titel „Only the Paranoid survive“. Ich würde es eher Wachsamkeit nennen. Erfolgreiche Gründer entwickeln schnell ein feines Gespür dafür, wann sich etwas verändert. Sie hinterfragen sich regelmäßig, ohne sich ständig neu zu erfinden. Das ist ein kontinuierlicher Lernmodus. Wer bestehen will, braucht die Fähigkeit, Stabilität und Bewegung gleichzeitig zu organisieren. Das war schon immer so, ist in der schnelllebigen Wirtschaftswelt von heute aber noch wichtiger.

21 % nutzen bewusst externe Impulse und Netzwerke, um Stillstand zu überwinden. Warum ist das „Schmoren im eigenen Saft“ für junge Unternehmen gefährlicher als jede(r) Wettbewerber*in?

Dr. Jenkis: Weil es die Wahrnehmung verengt. Wenn man nur mit Menschen spricht, die ähnlich denken, entstehen schnell Echokammern. Ideen klingen in der eigenen Blase immer besser, als sie wirklich sind. Risiken werden ausgeblendet, blinde Flecken übersehen. Externe Impulse dagegen bringen Reibung. Und genau diese Reibung sorgt für Klarheit. Wer mit offenen Augen und Ohren durch die Welt geht, sich für Neues begeistert und sich bewusst von anderen – etwa Mentoren oder Sparringspartnern – hinterfragen lässt, entwickelt sich weiter. Wettbewerb fordert von außen. Selbstüberschätzung entsteht von innen.

Im „Museum des Scheiterns“ Ihrer Befragten hängen eher leise Fehlentscheidungen wie unpassende Teams oder kulturelle Blockaden. Was ist die wichtigste Lektion, die Gründende aus diesen strukturellen Fehlern ziehen können?

Dr. Jenkis: Erfolg entscheidet sich selten an der Idee. Vielmehr sind es die Menschen und ihre Art, wie sie zusammenarbeiten. Denn die meisten Probleme entstehen nicht spektakulär, sondern schleichend. Falsche Besetzungen, unklare Kommunikation, fehlendes Vertrauen. Die wichtigste Lektion ist deshalb: Organisation und Kultur sind keine Nebenthemen. Sie sind der Kern unternehmerischen Erfolgs. Darum hier nochmal die klassischen Zitate von Peter Drucker und Safi Bahcall: „Culture eats strategy for breakfast. Structure eats culture for lunch.“

Zum Abschluss: Sie ziehen in Ihrer Studie einen Vergleich zur historischen Fernfahrt von Bertha Benz und sagen: Die Ideen stehen bereit, aber der Weg muss frei werden. Wenn wir dieses Bild auf heute übertragen: Welche eine strukturelle Weiche muss die Politik jetzt stellen, damit die nächste große Idee in Deutschland endlich freie Fahrt bekommt?“

Dr. Jenkis: Verlässlichkeit. Unternehmer können mit Unsicherheit umgehen. Was sie brauchen, sind klare, stabile Rahmenbedingungen. Wenn Regeln nachvollziehbar sind und auf Freiheiten bieten, Verfahren schnell laufen und Entscheidungen planbar werden, entsteht automatisch mehr Bewegung. Die Ideen stehen bereit. Die Menschen auch. Jetzt geht es darum, die Straße so zu gestalten, dass sie frei bleibt.

Dr. Jenkis, Danke für die spannenden Insights!

Das Interview führte StartingUp-Chefredakteur Hans Luthardt

110-Mio.-Dollar-Turbo: Sereact verpasst Robotern eine Vorstellungskraft

Mit 110 Mio. Dollar frischem Kapital und „Cortex 2“ greift das Stuttgarter Start-up Sereact die USA an. Die Vision: Roboter, die physikalisch mitdenken, statt nur blind zuzugreifen.

Das 2021 gegründete Stuttgarter Start-up Sereact hat in einer aktuellen Serie-B-Finanzierungsrunde 110 Millionen US-Dollar eingesammelt. Mit dem Versprechen, Industrierobotern durch sogenannte „Weltmodelle“ eine Art situative Vorstellungskraft zu verleihen, zieht das Unternehmen erneut internationale Schwergewichte an. Doch während die Kriegskasse für die anstehende US-Expansion prall gefüllt ist, stellt sich die Frage: Kann der datengetriebene Ansatz aus dem Schwabenland die hochfinanzierte US-Konkurrenz auf ihrem Heimatmarkt wirklich ausstechen? Eine Analyse.

Millionen-Spritze für den Weltmarkt

Die Gründungsgeschichte von Sereact liest sich wie ein europäischer Tech-Traum. Ralf Gulde (CEO) und Marc Tuscher (CTO) starteten 2021 als Ausgründung der Universität Stuttgart. Was mit improvisierten Servern aus gebrauchten Grafikkarten begann, hat sich zu einem globalen Geschäft entwickelt: Nach einer Serie-A-Runde im Jahr 2025 führt nun der VC Headline die 110-Millionen-Dollar-Runde an. Beteiligt sind zudem Bullhound Capital, Daphni und Felix Capital, womit das Gesamtkapital auf über 140 Millionen US-Dollar steigt.

Der Grund für das massive Interesse liegt in der Skalierbarkeit: Mit über 200 europaweit eingesetzten Systemen gilt Sereact als einer der am häufigsten eingesetzten Anbieter von KI-Kommissionierrobotern. Die Kundenliste umfasst Größen wie BMW, Mercedes-Benz, DHL, PepsiCo und die Österreichische Post.

Cortex 2: Denken vor dem Greifen

Bisher basierte der Erfolg auf der Koppelung von Sprachmodellen und Bilderkennung. Mit der neuen Generation „Cortex 2“ geht Sereact einen Schritt weiter: Das System erweitert ein Vision-Language-Action-Modell (VLA) um ein „Weltmodell“. Anstatt nur zu reagieren, gleicht die KI Aktionen mit einem erlernten Modell der Physik ab und wählt den vielversprechendsten Weg aus.

Dieser Wechsel vom Reagieren zum Schlussfolgern ermöglicht komplexe Aufgaben, bei denen feinfühliger Kontakt entscheidend ist – etwa das Zusammenbauen von Komponenten unter Spannung oder das kratzerfreie Anbringen eines Scheibenwischers. CTO Marc Tuscher betont: „Wir bauen keine Roboter. [...] Die Hardware wird zur Massenware. Das Modell nicht.“

Der Eine-Milliarde-Picks-Vorsprung

Sereact positioniert sich als reines Software-Unternehmen, sieht seinen entscheidenden Vorteil jedoch in der Datenqualität. Ein kritischer Blick auf den Markt zeigt:

- Reale Daten vs. Simulation: Während viele Wettbewerber mit simulierten Daten trainieren, wurde Cortex 2 auf Basis von mehr als einer Milliarde realer Greifvorgänge aus der Produktion entwickelt.

- Nachgewiesene Präzision: Sereact begegnet der Skepsis gegenüber KI in der Logistik mit harten Zahlen. Laut Unternehmen erfordert nur noch jeder 53.000. Kommissioniervorgang ein menschliches Eingreifen.

- Hardware-Abhängigkeit: Trotz der Software-Stärke bleibt Sereact darauf angewiesen, dass Kunden in moderne Roboterarme und Sensorsysteme wie die hauseigene „Sereact Lens“ investieren.

Showdown in den USA

Mit der Präsentation auf der MODEX in Atlanta und der geplanten Eröffnung eines Büros in Boston in diesem Sommer bläst Sereact zum Angriff auf den US-Markt. Amerikanische Hersteller fordern produktreife KI, die sofort einsatzbereit ist.

Für die Gründer*innenszene sendet Sereact ein klares Signal: Der nächste Paradigmenwechsel der KI findet in der physischen Welt statt (Embodied AI). Der Erfolg in den USA wird davon abhängen, ob das Stuttgarter Daten-Flywheel auch gegen die gigantischen Budgets der US-Konkurrenz bestehen kann. Sereact hat den Grundstein gelegt, um das „Gehirn“ der globalen Automatisierung zu werden.

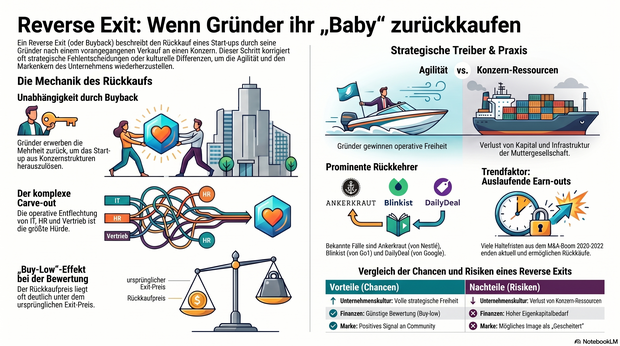

Reverse Exit: Wenn der Exit den Rückwärtsgang einlegt

In jüngster Zeit häufen sich in der Start-up-Szene Fälle, in denen Gründer*innen ihr Lebenswerk nach einem Exit überraschend zurückkaufen. Wir zeigen, was es mit dem Reverse Exit auf sich hat.

Für die meisten Gründer*innen ist er das ultimative Ziel auf der Start-up-Reise: der Exit. Doch was passiert, wenn die Traumhochzeit mit dem Konzern oder dem/der Großinvestor*in im Alltagstresor der Konzernstrukturen erstickt? Der sogenannte Reverse Exit rückt in den Fokus – und wirft für angehende wie gestandene Gründer*innen die Frage auf, ob ein Verkauf wirklich immer das Ende der eigenen Unternehmensgeschichte sein muss.

Was ist ein Reverse Exit?

Ein Reverse Exit (oft auch als Buyback oder Management Buyout / MBO nach einem vorherigen Verkauf bezeichnet) beschreibt den Vorgang, bei dem die ursprünglichen Gründer*innen oder das Managementteam die Mehrheit oder alle Anteile ihres Start-ups von dem/der bisherigen Käufer*in zurückerwerben. Das Start-up wird dadurch aus den Strukturen des Konzerns oder der Investor*innengruppe herausgelöst und agiert wieder als eigenständiges, unabhängiges Unternehmen.

Motivation der Beteiligten: Warum die Rolle rückwärts?

Ein Reverse Exit geschieht selten aus einer Laune heraus. Er ist zumeist das Ergebnis eines Reifeprozesses, bei dem beide Seiten erkennen, dass getrennte Wege wirtschaftlich und strategisch sinnvoller sind.

- Motivation der Gründer*innen (Käufer*innen): Oft prallen nach einem Exit die agile Start-up-Kultur und starre Konzernprozesse schmerzhaft aufeinander. Gründer*innen wollen die operative Entscheidungsgewalt zurückerlangen, eine verwässerte Markenidentität retten oder das Unternehmen schnell auf neue Markttrends (wie aktuell künstliche Intelligenz) ausrichten, was im Konzerngeflecht schlicht zu lange dauern würde.

- Motivation der Corporates (Verkäufer*innen): Konzerne trennen sich meist wieder von ihren Zukäufen, wenn das Start-up die erhofften Synergien nicht bringt oder die Umsätze nach der Übernahme stagnieren. Manchmal ändern sich auch die strategischen Kernziele des Mutterkonzerns, sodass das Start-up als „Non-Core-Asset“ wieder abgestoßen wird.

Vor- und Nachteile eines Reverse Exits

Der Rückkauf des eigenen „Babys“ mag romantisch klingen, ist wirtschaftlich aber ein enormer Kraftakt. Die wichtigsten Aspekte im Überblick:

Aspekt | Vorteile (Chancen) | Nachteile (Risiken) |

Unternehmenskultur | Volle strategische Freiheit und Rückbesinnung auf den ursprünglichen Markenkern | Verlust der Konzern-Ressourcen (Kapital, Vertriebsnetzwerk, Infrastruktur) |

Finanzen | Chance auf eine günstige Unternehmensbewertung beim Rückkauf (Buy-low-Effekt) | Hoher Kapitalbedarf für den Erwerb und das anschließende operative Geschäft |

Image & Marke | Starkes, positives Signal an die Community und Mitarbeiter („Wir sind wieder da“) | Reputationsrisiko bei künftigen B2B-Partner*innen, möglicher „Gescheitert“-Stempel |

Neben diesen offensichtlichen Punkten gibt es weitere, tieferliegende Schmerzpunkte, die bei einem Buyback zwingend auf dem Schirm sein müssen:

- B2B-Kund*innen und „Change of Control“-Klauseln: Große Enterprise-Kund*innen arbeiten oft gern mit Start-ups zusammen, weil im Hintergrund ein bonitätsstarker Konzern steht. Fällt dieses Sicherheitsnetz weg, greifen in Verträgen oft sogenannte Change of Control-Klauseln. Diese räumen den Kun*innen ein Sonderkündigungsrecht ein, weshalb wichtige Großkund*innen oft mühsam neu verhandelt werden müssen.

- Die Mitarbeitendenperspektive & ESOPs: Bei einem Exit werden Mitarbeitendenbeteiligungsprogramme (ESOPs/VSOPs) oft ausbezahlt und verfallen danach. Beim Rückkauf fängt das Start-up in Sachen Mitarbeitenden-Incentivierung oft wieder bei null an. Zudem bedeutet der Wegfall der Konzernstrukturen für manche Mitarbeitenden einen Verlust an Sicherheit (z.B. keine Konzern-Boni mehr), was den Buyback zu einem massiven HR-Kraftakt macht.

- Wem gehört das IP? (Geistiges Eigentum): Die Herauslösung von Patenten, Code oder Markenrechten, die während der Konzernzugehörigkeit entwickelt wurden, ist ein rechtliches Schlachtfeld. Gründer*innen müssen absichern, dass sie wirklich die uneingeschränkten Rechte an ihrem eigenen Produkt zurückkaufen.

Wie geht ein Reverse Exit vonstatten?

Der Prozess eines Rückkaufs ist oft deutlich komplizierter als der ursprüngliche Exit, da das Start.up bereits administrativ in den Konzern integriert wurde. Ein typischer Ablauf vollzieht sich in vier Schritten:

- Initiierung und Sondierung: Zumeist nach strategischen Differenzen oder Umstrukturierungen im Konzern treten die Gründer*innen mit einem Übernahmeangebot an den Eigentümer*innen heran.

- Unternehmensbewertung: Eine neue Due Diligence ist notwendig. Da das Wachstum im Konzern oft stagnierte oder Markenwerte gelitten haben, liegt der Kaufpreis häufig deutlich unter der damaligen Exit-Bewertung.

- Finanzierung: Die Gründer*innen müssen das Kapital aufbringen. Dies geschieht in der Regel durch das persönliche Vermögen aus dem ersten Exit, klassische Bankkredite oder die Hereinnahme spezialisierter Private-Equity-Partner*innen. Hier lauern zudem steuerliche Fallstricke: Der Rückkauf muss klug strukturiert werden (z.B. über eine Holding), um keine unnötigen steuerlichen Belastungen wie verdeckte Gewinnausschüttungen oder ungünstige Bewertungen durch das Finanzamt auszulösen.

- Carve-out (Herauslösung): Das ist die größte operative Hürde. IT-Systeme, HR-Prozesse, Buchhaltung und Vertriebslinien, die teilweise über Jahre mit dem Konzern verschmolzen wurden, müssen entflochten und eigenständig neu aufgebaut werden.

Reverse Exits in der Praxis: Von historischen Blueprints zu aktuellen Paukenschlägen

Dass der Reverse Exit kein reines Theoriekonstrukt ist, beweisen zahlreiche Beispiele aus der DACH-Region. Er ist keine völlige Neuerscheinung, sondern hat sich über die Jahre als strategisches Werkzeug etabliert:

Die historischen und B2B-Blaupausen

- DailyDeal (Exit: 2011 / Rückkauf: 2013): Die „Mutter aller Reverse Exits“ in Deutschland. Die Brüder Fabian und Ferry Heilemann verkauften ihr Gutschein-Portal 2011 für über 100 Millionen Dollar an Google. Als der Konzern das Interesse am kleinteiligen europäischen Markt verlor, kauften sie es 2013 für einen Bruchteil zurück, sanierten es und verkauften es 2015 ein zweites Mal erfolgreich.

- Holvi (Exit: 2016 / Rückkauf: 2021): Das finnisch-deutsche Business-Banking-Fintech wurde 2016 von der spanischen Großbank BBVA übernommen. Als sich die Bank strategisch neu aufstellte, kaufte Gründer Tuomas Toivonen sein Start-up 2021 zurück, um die Produktstrategie wieder agil und ohne bankenübliche Compliance-Bremsen zu steuern.

- FastBill (Exit: 2021 / Rückkauf: 2024): Die Frankfurter Buchhaltungs-Pioniere verkauften an den kanadischen Konkurrenten FreshBooks. Nach internen Umstrukturierungen des Käufers und dessen Rückzug aus Europa zogen die FastBill-Gründer René Maudrich und Benjamin Kirschner einen Management Buyout durch und operieren seither wieder eigenständig und profitabel.

Aktuelle Schlagzeilen im April 2026

Zuletzt sorgten zudem hochkarätige B2C-Fälle für großes Aufsehen in den Wirtschaftsmedien:

- Ankerkraut: Der Hamburger Gewürzhersteller löste 2022 ein massives Medienecho aus, als der Verkauf an Nestlé zu einem beispiellosen Shitstorm führte. Nach exakt vier Jahren unter Konzernführung haben die Gründer*innen Anne und Stefan Lemcke ihre Marke nun überraschend zurückgekauft. Das klare Ziel: Ein strategischer Neustart und das Wiedererlangen des verlorenen Community-Vertrauens.

- Blinkist: Das Berliner Medien-Grownup wurde erst 2023 vom australischen Lern-Konzern Go1 übernommen. Knapp drei Jahre später gaben die Gründer Holger Seim und Tobias Balling den vollständigen Rückkauf bekannt. Der Grund war hier eine friedliche strategische Neuausrichtung: Die Gründer wollten vor allem die neuen Potenziale von künstlicher Intelligenz völlig frei und ohne Konzernbremse ausschöpfen.

Steht Deutschland vor einer Welle an Reverse Exits?

Die spannende Frage für die hiesige Gründer*innenszene lautet: Sind diese Fälle nur prominente Ausreißer, oder markieren sie den Beginn eines handfesten Trends? Vieles deutet auf eine Zunahme von Reverse Exits hin. Dafür gibt es drei starke Treiber:

- Auslaufende Earn-out-Phasen: Im M&A-Boom der Jahre 2020 bis 2022 wurden Gründer*innen oft für drei bis vier Jahre vertraglich an den/die Käufer*in gebunden. Diese Fristen laufen aktuell massenhaft aus. Gründer*innen haben nun das Kapital aus dem Exit und gleichzeitig die Freiheit, ihr altes Unternehmen zurückzukaufen, falls die Entwicklung im Konzern stagniert.

- Strategische Portfolio-Bereinigung: Das makroökonomische Umfeld ist rauer geworden. Konzerne prüfen ihre damaligen Innovations-Wetten nun streng auf Profitabilität. Start-ups, die sich nicht nahtlos integrieren ließen, werden abgestoßen – ein historisches Zeitfenster für günstige Rückkäufe.

- Die Geschwindigkeit technologischer Umbrüche: Wir erleben rasante Innovationszyklen. Konzernstrukturen mit langwierigen Legal-Checks erweisen sich oft als Bremsklotz. Gründer*innen, die ihr Produkt radikal umbauen wollen, sehen den Rückkauf oft als einzigen Weg, um überlebensfähig zu bleiben.

Achtung, Survivorship Bias: Wenn der Rückkauf scheitert

Ein massenhafter „Exodus“ aus den Konzernen steht zwar nicht bevor, da ein Reverse Exit operativ und finanziell ein Kraftakt bleibt. Zudem trügt bei den prominenten Beispielen oft der sogenannte Survivorship Bias: Wir hören in den Medien meist nur von den mutigen, erfolgreichen Rückkehrer*innen. Doch nicht jeder Buyback glückt. Selbst das Pionier-Beispiel DailyDeal musste Jahre nach dem glorreichen Rückkauf (unter späterer, neuer Führung) letztlich doch Insolvenz anmelden. Andere Start-ups haben nach der Trennung vom Konzern den Anschluss an den Markt schlichtweg nicht mehr gefunden. Ein Reverse Exit ist keine Erfolgsgarantie, sondern lediglich eine hart erarbeitete zweite Chance.

Dennoch wandelt sich der Buyback vom Nischenphänomen zur etablierten Option. Der Exit ist keine Einbahnstraße. Die prominenten Fälle verdeutlichen eindrucksvoll, dass ein hoher Verkaufspreis allein keine glückliche Zukunft im Konzernverbund garantiert. Wenn Start-up-Agilität und Konzern-Compliance unvorbereitet aufeinanderprallen, ziehen oft beide Seiten den Kürzeren. Wer sein Unternehmen zurückkauft, tut dies nicht aus reiner Nostalgie, sondern weil er unerschütterlich an das noch ungenutzte Potenzial seiner Ursprungsidee glaubt.

Das Learning für künftige Gründer*innen: Verhandelt bei einem Exit nicht nur über Multiples und Earn-outs, sondern prüft den kulturellen Fit ganz genau. Und behaltet euch – sofern vertraglich und strategisch möglich – immer im Hinterkopf, dass der Traum vom Exit notfalls auch durch einen mutigen Rückkauf korrigiert werden kann.

Omegga sichert 10 Mio. EUR gegen das Kükentöten

Das 2020 gegründete Münchner Start-up Omegga sichert sich Seed-Kapital für seine optische KI-Spektroskopie. Unsere Marktanalyse.

Omegga wurde 2020 von Katharina Hesseler, Till Nöllgen und Paul Günther gegründet. Zum erweiterten Gründer:innenkreis gehören zudem Moritz Eder, Kyle Hiroyasu und Clara Kaufhold. Das Team bündelt Expertise in den Bereichen KI, Optik und industrielle Systeme. In den vergangenen Jahren entwickelte das Team seine Technologie kontinuierlich vom Prototypen zum Industriestandard weiter und konnte sich bereits 2023 eine Pre-Seed-Finanzierung sowie 2024 Fördermittel des European Innovation Council (EIC) sichern.

CEO und Mitgründerin Katharina Hesseler sieht in dem Einstieg der neuen Partner, die „tiefes technologisches Verständnis mitbringen“, ein „starkes Signal für das enorme Potenzial unseres Ansatzes, einen neuen Standard in der Industrie zu setzen“. Das frische Kapital soll in den gezielten Ausbau des Teams und die kommerzielle Skalierung der Technologie fließen.

Das Problem und die technologische Lösung

Der erste und bereits kommerziell verfügbare Use Case von Omegga widmet sich einem der massivsten ethischen Probleme der modernen Landwirtschaft. Jährlich werden weltweit Milliarden männlicher Küken direkt nach dem Schlüpfen getötet, da sie weder Eier legen noch für die Masthaltung wirtschaftlich nutzbar sind.